Guía de diseño del sistema

Diseño de un sistema RHEL 8

Resumen

Hacer que el código abierto sea más inclusivo

Red Hat se compromete a sustituir el lenguaje problemático en nuestro código, documentación y propiedades web. Estamos empezando con estos cuatro términos: maestro, esclavo, lista negra y lista blanca. Debido a la enormidad de este esfuerzo, estos cambios se implementarán gradualmente a lo largo de varias versiones próximas. Para más detalles, consulte el mensaje de nuestro CTO Chris Wright.

Proporcionar comentarios sobre la documentación de Red Hat

Agradecemos su opinión sobre nuestra documentación. Por favor, díganos cómo podemos mejorarla. Para ello:

Para comentarios sencillos sobre pasajes concretos:

- Asegúrese de que está viendo la documentación en el formato Multi-page HTML. Además, asegúrese de ver el botón Feedback en la esquina superior derecha del documento.

- Utilice el cursor del ratón para resaltar la parte del texto que desea comentar.

- Haga clic en la ventana emergente Add Feedback que aparece debajo del texto resaltado.

- Siga las instrucciones mostradas.

Para enviar comentarios más complejos, cree un ticket de Bugzilla:

- Vaya al sitio web de Bugzilla.

- Como componente, utilice Documentation.

- Rellene el campo Description con su sugerencia de mejora. Incluya un enlace a la(s) parte(s) pertinente(s) de la documentación.

- Haga clic en Submit Bug.

Parte I. Diseño de la instalación

Capítulo 1. Introducción

Red Hat Enterprise Linux 8 ofrece una base estable, segura y consistente en las implementaciones de nube híbrida con las herramientas necesarias para entregar las cargas de trabajo más rápidamente con menos esfuerzo. Puede desplegarse como invitado en hipervisores y entornos de proveedores de nube compatibles, así como desplegarse en infraestructura física, para que sus aplicaciones puedan aprovechar las innovaciones de las principales plataformas de arquitectura de hardware.

1.1. Arquitecturas soportadas

Red Hat Enterprise Linux es compatible con las siguientes arquitecturas:

- Arquitecturas AMD, Intel y ARM de 64 bits

IBM Power Systems, Little Endian

- Servidores IBM Power System LC

- Servidores IBM Power System AC

- Servidores IBM Power System L

- IBM Z

1.2. Terminología de la instalación

Esta sección describe la terminología de instalación de Red Hat Enterprise Linux. Se puede utilizar diferente terminología para los mismos conceptos, dependiendo de su origen ascendente o descendente.

Anaconda: El instalador del sistema operativo utilizado en Fedora, Red Hat Enterprise Linux y sus derivados. Anaconda es un conjunto de módulos y scripts de Python con archivos adicionales como widgets Gtk (escritos en C), unidades systemd y bibliotecas dracut. Juntos, forman una herramienta que permite a los usuarios establecer los parámetros del sistema (objetivo) resultante. En este documento, el término installation program se refiere al aspecto de instalación de Anaconda.

Capítulo 2. Preparación de la instalación

Antes de comenzar a instalar Red Hat Enterprise Linux, revise las siguientes secciones para preparar su configuración para la instalación.

2.1. Pasos recomendados

La preparación de la instalación de RHEL consiste en los siguientes pasos:

Pasos

- Revise y determine el método de instalación.

- Comprueba los requisitos del sistema.

- Revise las opciones de medios de arranque de la instalación.

- Descargue la imagen ISO de instalación necesaria.

- Cree un medio de instalación de arranque.

- Preparar el origen de la instalación*

*Sólo se requiere para la imagen ISO de arranque (instalación mínima) si no se utiliza la red de distribución de contenidos (CDN) para descargar los paquetes de software necesarios.

2.2. Métodos de instalación disponibles

Puede instalar Red Hat Enterprise Linux utilizando cualquiera de los siguientes métodos:

- Instalaciones basadas en GUI

- Instalaciones basadas en imágenes del sistema o de la nube

- Instalaciones avanzadas

Este documento proporciona detalles sobre la instalación de RHEL utilizando las interfaces de usuario (GUI).

Instalaciones basadas en GUI

Existen los siguientes métodos de instalación basados en la GUI:

- Install RHEL using an ISO image from the Customer Portal: Instale Red Hat Enterprise Linux descargando el archivo de imagen Binary DVD ISO desde el Portal del Cliente. El registro se realiza una vez finalizada la instalación de la interfaz gráfica de usuario. Este método de instalación también es soportado por Kickstart.

Register and install RHEL from the Content Delivery Network: Registre su sistema, adjunte suscripciones e instale Red Hat Enterprise Linux desde la Red de Entrega de Contenido (CDN). Este método de instalación es soportado por los archivos de imagen Boot ISO y Binary DVD ISO; sin embargo, se recomienda que utilice el archivo de imagen Boot ISO ya que el origen de la instalación es por defecto CDN para el archivo de imagen Boot ISO. El registro se realiza antes de descargar e instalar los paquetes de instalación desde la CDN. Este método de instalación también es compatible con Kickstart.

ImportantePuede personalizar la instalación de RHEL para sus requisitos específicos utilizando la interfaz gráfica de usuario. Puede seleccionar opciones adicionales para requisitos específicos del entorno, por ejemplo, Conectar con Red Hat, selección de software, particionamiento, seguridad y muchos más. Para más información, consulte Capítulo 4, Personalización de la instalación.

Instalaciones basadas en imágenes del sistema o de la nube

Puede utilizar métodos de instalación basados en imágenes del sistema o de la nube sólo en entornos virtuales y de la nube.

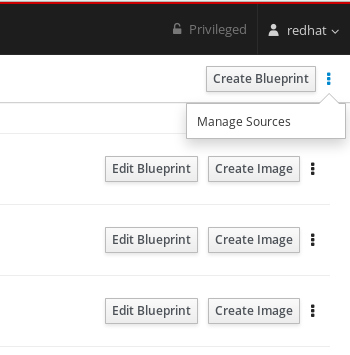

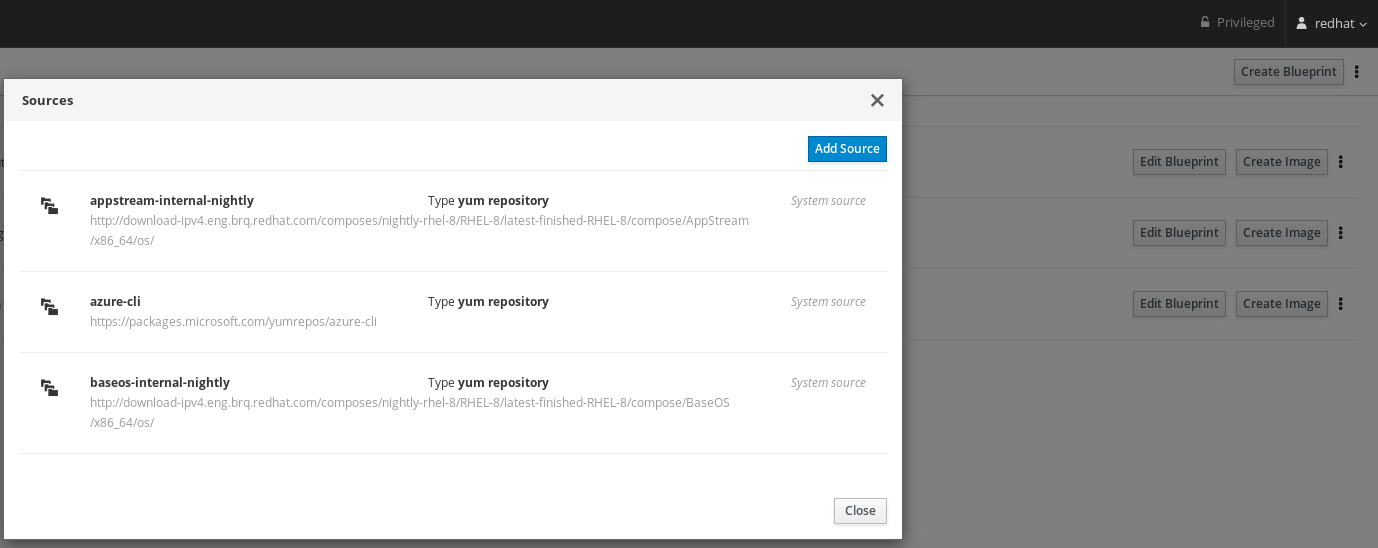

Para realizar una instalación basada en imágenes de sistema o de nube, utilice Red Hat Image Builder. Image Builder crea imágenes de sistema personalizadas de Red Hat Enterprise Linux, incluyendo las imágenes de sistema para la implementación en la nube.

Para obtener más información sobre la instalación de RHEL mediante Image Builder, consulte el Composing a customized RHEL system image documento.

Instalaciones avanzadas

Existen los siguientes métodos avanzados de instalación:

- Perform an automated RHEL installation using Kickstart: Instalar Red Hat Enterprise Linux usando Kickstart. Kickstart es una instalación automatizada que le permite ejecutar tareas de instalación del sistema operativo sin supervisión.

- Perform a remote RHEL installation using VNC: El programa de instalación de RHEL ofrece dos modos de instalación de VNC: Directo y Conectado. Una vez establecida la conexión, los dos modos no difieren. El modo que seleccione depende de su entorno.

- Install RHEL from the network using PXE : Una instalación en red le permite instalar Red Hat Enterprise Linux en un sistema que tiene acceso a un servidor de instalación. Como mínimo, se requieren dos sistemas para una instalación en red.

Para más información sobre los métodos avanzados de instalación, consulte el Performing an advanced RHEL installation documento.

2.3. Requisitos del sistema

Si es la primera vez que instala Red Hat Enterprise Linux, se recomienda que revise las directrices proporcionadas para el sistema, el hardware, la seguridad, la memoria y el RAID antes de la instalación. Vea la referencia de los requisitos del sistema para más información.

2.4. Opciones de medios de arranque de la instalación

Hay varias opciones disponibles para arrancar el programa de instalación de Red Hat Enterprise Linux.

- DVD de instalación completa o unidad flash USB

- Cree un DVD de instalación completa o una unidad flash USB utilizando la imagen Binary DVD ISO. El DVD o la unidad flash USB pueden utilizarse como dispositivo de arranque y como fuente de instalación para instalar paquetes de software. Debido al tamaño de la imagen ISO del DVD binario, se recomienda utilizar un DVD o una unidad flash USB.

- Instalación mínima en DVD, CD o unidad flash USB

- Cree un CD, DVD o unidad flash USB de instalación mínima utilizando la imagen Boot ISO, que sólo contiene los archivos mínimos necesarios para arrancar el sistema e iniciar el programa de instalación.

Si no utiliza la red de distribución de contenidos (CDN) para descargar los paquetes de software necesarios, la imagen Boot ISO requiere una fuente de instalación que contenga los paquetes de software necesarios.

- Servidor PXE

- Un servidor preboot execution environment (PXE) permite que el programa de instalación arranque a través de la red. Después de un arranque del sistema, debe completar la instalación desde una fuente de instalación diferente, como un disco duro local o una ubicación de red.

- Constructor de imágenes

- Image Builder permite crear imágenes de sistema y de nube personalizadas para instalar Red Hat Enterprise Linux en un entorno virtual y de nube.

Recursos adicionales

- Para más información sobre los servidores PXE, consulte el Performing an advanced RHEL installation documento.

- Para más información sobre el Constructor de imágenes, consulte el Composing a customized RHEL system image documento.

2.5. Tipos de imágenes ISO de instalación

Hay dos tipos de imágenes ISO de instalación de Red Hat Enterprise Linux 8 disponibles en el Portal del Cliente de Red Hat.

- Archivo de imagen ISO de DVD binario

Un programa de instalación completo que contiene los repositorios de BaseOS y AppStream y permite completar la instalación sin repositorios adicionales.

ImportantePuede utilizar un DVD binario para IBM Z para arrancar el programa de instalación utilizando una unidad de DVD SCSI, o como fuente de instalación.

- Archivo de imagen ISO de arranque

La imagen Boot ISO es una instalación mínima que puede utilizarse para instalar RHEL de dos maneras diferentes:

- Al registrar e instalar RHEL desde la Red de Entrega de Contenidos (CDN).

- Como una imagen mínima que requiere acceso a los repositorios de BaseOS y AppStream para instalar paquetes de software. Los repositorios forman parte de la imagen ISO del DVD Binario que está disponible para su descarga en https://access.redhat.com/home. Descargue y descomprima la imagen ISO del DVD Binario para acceder a los repositorios.

La siguiente tabla contiene información sobre las imágenes disponibles para las arquitecturas soportadas.

| Arquitectura | DVD de instalación | DVD de arranque |

|---|---|---|

| AMD64 e Intel 64 | x86_64 Archivo de imagen ISO de DVD binario | archivo de imagen ISO de arranque x86_64 |

| ARM 64 | Archivo de imagen ISO de DVD binario AArch64 | Archivo de imagen ISO de arranque AArch64 |

| IBM POWER | ppc64le Archivo de imagen ISO de DVD binario | archivo de imagen ISO de arranque ppc64le |

| IBM Z | s390x Archivo de imagen ISO de DVD binario | archivo de imagen ISO de arranque s390x |

2.6. Descarga de la imagen ISO de instalación

Esta sección contiene instrucciones sobre cómo descargar una imagen de instalación de Red Hat Enterprise Linux desde el Portal del Cliente de Red Hat o mediante el comando curl.

2.6.1. Descarga de una imagen ISO desde el Portal del Cliente

Siga este procedimiento para descargar un archivo de imagen ISO de Red Hat Enterprise Linux 8 desde el Portal del Cliente de Red Hat.

- La imagen Boot ISO es un archivo de imagen mínimo que permite registrar el sistema, adjuntar suscripciones e instalar RHEL desde la red de distribución de contenidos (CDN).

- El archivo de imagen ISO del DVD binario contiene todos los repositorios y paquetes de software y no requiere ninguna configuración adicional.

Requisitos previos

- Tiene una suscripción activa a Red Hat.

- Ha iniciado la sesión en la sección Product Downloads del Portal del Cliente de Red Hat en https://access.redhat.com/downloads.

Procedimiento

- En la página Product Downloads, seleccione la pestaña By Category.

Haga clic en el enlace Red Hat Enterprise Linux 8.

Se abre la página web Download Red Hat Enterprise Linux.

En el menú desplegable Product Variant, seleccione la variante que desee.

- Opcional: Seleccione la pestaña Packages para ver los paquetes contenidos en la variante seleccionada. Para obtener información sobre los paquetes disponibles en Red Hat Enterprise Linux 8, consulte el documento Package Manifest.

- En el menú desplegable Version aparece por defecto la última versión de la variante seleccionada.

El menú desplegable Architecture muestra la arquitectura soportada.

La pestaña Product Software muestra los archivos de imagen, que incluyen:

- Red Hat Enterprise Linux Binary DVD imagen.

- Red Hat Enterprise Linux Boot ISO imagen.

Puede haber imágenes adicionales, por ejemplo, imágenes de máquinas virtuales preconfiguradas, pero están fuera del alcance de este documento.

- Haga clic en junto a la imagen ISO que necesita.

2.6.2. Descarga de una imagen ISO mediante curl

Utilice el comando curl para descargar imágenes de instalación directamente desde una URL específica.

Requisitos previos

Compruebe que el paquete curl está instalado:

Si su distribución utiliza el gestor de paquetes yum:

# yum install curlSi su distribución utiliza el gestor de paquetes dnf:

# dnf install curlSi su distribución utiliza el gestor de paquetes apt:

# apt update # apt install curl- Si su distribución de Linux no utiliza yum, dnf o apt, o si no utiliza Linux, descargue el paquete de software más apropiado del sitio web de curl.

- Ha navegado a la sección Product Downloads del Portal del Cliente de Red Hat en https://access.redhat.com/downloads, y ha seleccionado la variante, la versión y la arquitectura que necesita. Ha hecho clic con el botón derecho en el archivo de imagen ISO requerido y ha seleccionado Copy Link Location para copiar la URL del archivo de imagen ISO en su portapapeles.

Procedimiento

En la línea de comandos, introduzca un directorio adecuado y ejecute el siguiente comando para descargar el archivo:

$ curl --output directory-path/filename.iso 'copied_link_location'Sustituya directory-path por una ruta de acceso a la ubicación en la que desea guardar el archivo; sustituya filename.iso por el nombre de la imagen ISO que aparece en el Portal del Cliente; sustituya copied_link_location por el enlace que ha copiado del Portal del Cliente.

2.7. Creación de un medio de instalación de arranque

Esta sección contiene información sobre cómo utilizar el archivo de imagen ISO que descargó en Sección 2.6, “Descarga de la imagen ISO de instalación” para crear un medio de instalación físico de arranque, como un USB, un DVD o un CD.

Por defecto, la opción de arranque inst.stage2= se utiliza en el medio de instalación y se establece en una etiqueta específica, por ejemplo, inst.stage2=hd:LABEL=RHEL8\x86_64. Si se modifica la etiqueta por defecto del sistema de archivos que contiene la imagen de ejecución, o si se utiliza un procedimiento personalizado para arrancar el sistema de instalación, se debe verificar que la etiqueta está configurada con el valor correcto.

2.7.1. Creación de un DVD o CD de arranque

Puede crear un DVD o CD de instalación de arranque utilizando un software de grabación y una grabadora de CD/DVD. Los pasos exactos para producir un DVD o CD a partir de un archivo de imagen ISO varían mucho, dependiendo del sistema operativo y del software de grabación de discos instalado. Consulte la documentación del software de grabación de su sistema para conocer los pasos exactos para grabar un CD o DVD a partir de un archivo de imagen ISO.

Puedes crear un DVD o CD de arranque utilizando la imagen ISO de DVD binario (instalación completa) o la imagen ISO de arranque (instalación mínima). Sin embargo, la imagen ISO del DVD binario tiene un tamaño superior a 4,7 GB, por lo que es posible que no quepa en un DVD de una o dos capas. Compruebe el tamaño del archivo de imagen ISO de DVD binario antes de continuar. Se recomienda utilizar una llave USB cuando se utiliza la imagen ISO de DVD binario para crear medios de instalación de arranque.

2.7.2. Creación de un dispositivo USB de arranque en Linux

Siga este procedimiento para crear un dispositivo USB de arranque en un sistema Linux.

Este procedimiento es destructivo y los datos de la memoria USB se destruyen sin previo aviso.

Requisitos previos

- Ha descargado una imagen ISO de instalación como se describe en Sección 2.6, “Descarga de la imagen ISO de instalación”.

- La imagen ISO de Binary DVD tiene un tamaño superior a 4,7 GB, por lo que se necesita una unidad flash USB lo suficientemente grande como para contener la imagen ISO.

Procedimiento

- Conecte la unidad flash USB al sistema.

Abra una ventana de terminal y ejecute el comando

dmesg:$ dmesg|tailEl comando

dmesgdevuelve un registro que detalla todos los eventos recientes. Los mensajes resultantes de la unidad flash USB conectada se muestran en la parte inferior del registro. Registre el nombre del dispositivo conectado.Cambia a usuario root:

$ su -- Introduzca su contraseña de root cuando se le solicite.

Busque el nodo de dispositivo asignado a la unidad. En este ejemplo, el nombre de la unidad es

sdd.# dmesg|tail [288954.686557] usb 2-1.8: New USB device strings: Mfr=0, Product=1, SerialNumber=2 [288954.686559] usb 2-1.8: Product: USB Storage [288954.686562] usb 2-1.8: SerialNumber: 000000009225 [288954.712590] usb-storage 2-1.8:1.0: USB Mass Storage device detected [288954.712687] scsi host6: usb-storage 2-1.8:1.0 [288954.712809] usbcore: registered new interface driver usb-storage [288954.716682] usbcore: registered new interface driver uas [288955.717140] scsi 6:0:0:0: Direct-Access Generic STORAGE DEVICE 9228 PQ: 0 ANSI: 0 [288955.717745] sd 6:0:0:0: Attached scsi generic sg4 type 0 [288961.876382] sd 6:0:0:0: sdd Attached SCSI removable diskEjecute el comando

ddpara escribir la imagen ISO directamente en el dispositivo USB.# dd if=/directorio_de_imágenes/imagen.iso of=/dev/dispositivoSustituya /image_directory/image.iso por la ruta completa del archivo de imagen ISO que ha descargado, y sustituya device por el nombre del dispositivo que ha recuperado con el comando

dmesg. En este ejemplo, la ruta completa a la imagen ISO es/home/testuser/Downloads/rhel-8-x86_64-boot.iso, y el nombre del dispositivo essdd:# dd if=/home/testuser/Downloads/rhel-8-x86_64-boot.iso of=/dev/sddNotaAsegúrese de utilizar el nombre correcto del dispositivo, y no el nombre de una partición en el dispositivo. Los nombres de las particiones suelen ser nombres de dispositivos con un sufijo numérico. Por ejemplo,

sddes un nombre de dispositivo, ysdd1es el nombre de una partición en el dispositivosdd.-

Espere a que el comando

ddtermine de escribir la imagen en el dispositivo. La transferencia de datos se habrá completado cuando aparezca el mensaje #. Cuando aparezca el indicador, cierre la sesión de la cuenta raíz y desconecte la unidad USB. La unidad USB ya está lista para ser utilizada como dispositivo de arranque.

2.7.3. Creación de un dispositivo USB de arranque en Windows

Siga los pasos de este procedimiento para crear un dispositivo USB de arranque en un sistema Windows. El procedimiento varía dependiendo de la herramienta. Red Hat recomienda utilizar Fedora Media Writer, disponible para su descarga en https://github.com/FedoraQt/MediaWriter/releases.

- Fedora Media Writer es un producto de la comunidad y no está soportado por Red Hat. Puede informar de cualquier problema con la herramienta en https://github.com/FedoraQt/MediaWriter/issues.

- Este procedimiento es destructivo y los datos de la memoria USB se destruyen sin previo aviso.

Requisitos previos

- Ha descargado una imagen ISO de instalación como se describe en Sección 2.6, “Descarga de la imagen ISO de instalación”.

- La imagen ISO de Binary DVD tiene un tamaño superior a 4,7 GB, por lo que se necesita una unidad flash USB lo suficientemente grande como para contener la imagen ISO.

Procedimiento

Descargue e instale Fedora Media Writer desde https://github.com/FedoraQt/MediaWriter/releases.

NotaPara instalar Fedora Media Writer en Red Hat Enterprise Linux, utilice el paquete Flatpak pre-construido. Puede obtener el paquete desde el repositorio oficial de Flatpak Flathub.org en https://flathub.org/apps/details/org.fedoraproject.MediaWriter.

- Conecte la unidad flash USB al sistema.

- Abrir Fedora Media Writer.

- En la ventana principal, haga clic en y seleccione la imagen ISO de Red Hat Enterprise Linux previamente descargada.

- En la ventana Write Custom Image, seleccione la unidad que desea utilizar.

- Haga clic en . Se inicia el proceso de creación del medio de arranque. No desconecte la unidad hasta que se complete la operación. La operación puede tardar varios minutos, dependiendo del tamaño de la imagen ISO y de la velocidad de escritura de la unidad USB.

- Cuando la operación se complete, desmonte la unidad USB. La unidad USB ya está lista para ser utilizada como dispositivo de arranque.

2.7.4. Creación de un dispositivo USB de arranque en Mac OS X

Siga los pasos de este procedimiento para crear un dispositivo USB de arranque en un sistema Mac OS X.

Este procedimiento es destructivo y los datos de la memoria USB se destruyen sin previo aviso.

Requisitos previos

- Ha descargado una imagen ISO de instalación como se describe en Sección 2.6, “Descarga de la imagen ISO de instalación”.

- La imagen ISO de Binary DVD tiene un tamaño superior a 4,7 GB, por lo que se necesita una unidad flash USB lo suficientemente grande como para contener la imagen ISO.

Procedimiento

- Conecte la unidad flash USB al sistema.

Identifique la ruta del dispositivo con el comando

diskutil list. La ruta del dispositivo tiene el formato de /dev/disknumber, donde número es el número del disco. Los discos se numeran empezando por el cero (0). Normalmente, el disco 0 es el disco de recuperación de OS X, y el disco 1 es la instalación principal de OS X. En el siguiente ejemplo, el dispositivo USB esdisk2:$ diskutil list /dev/disk0 #: TYPE NAME SIZE IDENTIFIER 0: GUID_partition_scheme *500.3 GB disk0 1: EFI EFI 209.7 MB disk0s1 2: Apple_CoreStorage 400.0 GB disk0s2 3: Apple_Boot Recovery HD 650.0 MB disk0s3 4: Apple_CoreStorage 98.8 GB disk0s4 5: Apple_Boot Recovery HD 650.0 MB disk0s5 /dev/disk1 #: TYPE NAME SIZE IDENTIFIER 0: Apple_HFS YosemiteHD *399.6 GB disk1 Logical Volume on disk0s1 8A142795-8036-48DF-9FC5-84506DFBB7B2 Unlocked Encrypted /dev/disk2 #: TYPE NAME SIZE IDENTIFIER 0: FDisk_partition_scheme *8.1 GB disk2 1: Windows_NTFS SanDisk USB 8.1 GB disk2s1- Para identificar su unidad flash USB, compare las columnas NOMBRE, TIPO y TAMAÑO con su unidad flash. Por ejemplo, el NOMBRE debería ser el título del icono de la unidad flash en la herramienta Finder. También puede comparar estos valores con los del panel de información de la unidad flash.

Utilice el comando

diskutil unmountDiskpara desmontar los volúmenes del sistema de archivos de la unidad flash:$ diskutil unmountDisk /dev/disknumber Unmount of all volumes on disknumber was successfulCuando el comando se completa, el icono de la unidad flash desaparece del escritorio. Si el icono no desaparece, es posible que haya seleccionado el disco equivocado. Al intentar desmontar el disco del sistema accidentalmente se produce un error en failed to unmount.

Inicie sesión como root:

$ su -- Introduzca su contraseña de root cuando se le solicite.

Utilice el comando

ddcomo parámetro del comando sudo para escribir la imagen ISO en la unidad flash:# sudo dd if=/ruta/imagen.iso of=/dev/rdisknumberNotaMac OS X proporciona tanto un archivo de bloque (/dev/disk*) como un dispositivo de caracteres (/dev/rdisk*) para cada dispositivo de almacenamiento. Escribir una imagen en el dispositivo de caracteres /dev/rdisknumber es más rápido que escribir en el dispositivo de bloques /dev/disknumber.

Para escribir el archivo /Users/user_name/Downloads/rhel-8-x86_64-boot.iso en el dispositivo /dev/rdisk2, ejecute el siguiente comando:

# sudo dd if=/nombre_de_usuario/Descargas/rhel-8-x86_64-boot.iso of=/dev/rdisk2-

Espere a que el comando

ddtermine de escribir la imagen en el dispositivo. La transferencia de datos se habrá completado cuando aparezca el mensaje #. Cuando aparezca el indicador, cierre la sesión de la cuenta raíz y desconecte la unidad USB. La unidad USB ya está lista para ser utilizada como dispositivo de arranque.

2.8. Preparación de una fuente de instalación

El archivo de imagen Boot ISO no incluye ningún repositorio o paquete de software; sólo contiene el programa de instalación y las herramientas necesarias para arrancar el sistema e iniciar la instalación. Esta sección contiene información sobre cómo crear un origen de instalación para la imagen ISO de arranque utilizando la imagen ISO de DVD binario que contiene los repositorios y paquetes de software necesarios.

Se requiere una fuente de instalación para el archivo de imagen ISO de arranque sólo si decide no registrar e instalar RHEL desde la Red de Entrega de Contenido (CDN).

2.8.1. Tipos de fuente de instalación

Puede utilizar una de las siguientes fuentes de instalación para las imágenes de arranque mínimo:

- DVD: Grabe la imagen ISO del DVD binario en un DVD. El programa de instalación instalará automáticamente los paquetes de software desde el DVD.

Hard drive or USB drive: Copie la imagen ISO del DVD binario en la unidad y configure el programa de instalación para instalar los paquetes de software desde la unidad. Si utiliza una unidad USB, compruebe que está conectada al sistema antes de comenzar la instalación. El programa de instalación no puede detectar el soporte una vez iniciada la instalación.

-

Hard drive limitation: La imagen ISO del DVD binario en el disco duro debe estar en una partición con un sistema de archivos que el programa de instalación pueda montar. Los sistemas de archivos compatibles son

xfs,ext2,ext3,ext4yvfat (FAT32).

AvisoEn los sistemas Microsoft Windows, el sistema de archivos por defecto utilizado al formatear los discos duros es NTFS. También está disponible el sistema de archivos exFAT. Sin embargo, ninguno de estos sistemas de archivos puede montarse durante la instalación. Si está creando un disco duro o una unidad USB como fuente de instalación en Microsoft Windows, compruebe que ha formateado la unidad como FAT32. Tenga en cuenta que el sistema de archivos FAT32 no puede almacenar archivos de más de 4 GiB.

En Red Hat Enterprise Linux 8, puede habilitar la instalación desde un directorio en un disco duro local. Para hacerlo, necesita copiar el contenido de la imagen ISO del DVD a un directorio en un disco duro y luego especificar el directorio como la fuente de instalación en lugar de la imagen ISO. Por ejemplo

inst.repo=hd:<device>:<path to the directory>-

Hard drive limitation: La imagen ISO del DVD binario en el disco duro debe estar en una partición con un sistema de archivos que el programa de instalación pueda montar. Los sistemas de archivos compatibles son

Network location: Copie la imagen ISO del DVD binario o el árbol de instalación (contenido extraído de la imagen ISO del DVD binario) en una ubicación de red y realice la instalación a través de la red utilizando los siguientes protocolos:

- NFS: La imagen ISO del DVD binario está en un recurso compartido del sistema de archivos de red (NFS).

- HTTPS, HTTP or FTP: El árbol de instalación está en una ubicación de red que es accesible a través de HTTP, HTTPS o FTP.

2.8.2. Especifique el origen de la instalación

Puede especificar el origen de la instalación utilizando cualquiera de los siguientes métodos:

- Graphical installation: Seleccione el origen de la instalación en la ventana Installation Source de la instalación gráfica.

- Boot option: Configure una opción de arranque personalizada para especificar el origen de la instalación.

- Kickstart file: Utilice el comando install en un archivo Kickstart para especificar el origen de la instalación. Consulte el documento Performing an advanced RHEL installation para más información.

2.8.3. Puertos para la instalación en red

La siguiente tabla enumera los puertos que deben estar abiertos en el servidor que proporciona los archivos para cada tipo de instalación basada en la red.

| Protocolo utilizado | Puertos a abrir |

|---|---|

| HTTP | 80 |

| HTTPS | 443 |

| FTP | 21 |

| NFS | 2049, 111, 20048 |

| TFTP | 69 |

Recursos adicionales

- Consulte el Securing networks documento para más información.

2.8.4. Creación de un origen de instalación en un servidor NFS

Siga los pasos de este procedimiento para colocar el origen de la instalación en un servidor NFS. Utilice este método de instalación para instalar varios sistemas desde un único origen, sin tener que conectarse a medios físicos.

Requisitos previos

- Usted tiene acceso de nivel de administrador a un servidor con Red Hat Enterprise Linux 8, y este servidor está en la misma red que el sistema a ser instalado.

- Ha descargado una imagen binaria de DVD. Consulte Descarga de la imagen ISO de instalación en el documento Performing a standard RHEL installation para obtener más información.

- Ha creado un CD, DVD o dispositivo USB de arranque a partir del archivo de imagen. Consulte Creación de medios de instalación desde el documento Performing a standard RHEL installation para obtener más información.

- Ha verificado que su cortafuegos permite que el sistema que está instalando acceda al origen de la instalación remota. Consulte Puertos para la instalación basada en la red del documento Performing a standard RHEL installation para obtener más información.

Procedimiento

Instale el paquete

nfs-utils:# yum install nfs-utils- Copie la imagen ISO del DVD binario en un directorio del servidor NFS.

Abra el archivo

/etc/exportscon un editor de texto y añada una línea con la siguiente sintaxis:/exported_directory/ clientsSustituya /exported_directory/ por la ruta completa del directorio con la imagen ISO. Sustituya clients por el nombre de host o la dirección IP del sistema de destino, la subred que todos los sistemas de destino pueden utilizar para acceder a la imagen ISO, o el signo de asterisco (

*) si desea permitir que cualquier sistema con acceso de red al servidor NFS utilice la imagen ISO. Consulte la página de manualexports(5)para obtener información detallada sobre el formato de este campo.Una configuración básica que hace que el directorio

/rhel8-install/esté disponible como de sólo lectura para todos los clientes es:/rhel8-install *-

Guarde el archivo

/etc/exportsy salga del editor de texto. Inicie el servicio nfs:

# systemctl start nfs-server.serviceSi el servicio se estaba ejecutando antes de cambiar el archivo

/etc/exports, ejecute el siguiente comando para el servidor NFS en ejecución para recargar su configuración:# systemctl reload nfs-server.serviceLa imagen ISO es ahora accesible a través de NFS y está lista para ser utilizada como fuente de instalación.

Cuando configure el origen de la instalación, utilice nfs: como protocolo, el nombre del servidor o la dirección IP, el signo de dos puntos (:), y el directorio que contiene la imagen ISO. Por ejemplo, si el nombre del servidor es myserver.example.com y ha guardado la imagen ISO en /rhel8-install/, especifique nfs:myserver.example.com:/rhel8-install/ como origen de la instalación.

2.8.5. Creación de un origen de instalación mediante HTTP o HTTPS

Siga los pasos de este procedimiento para crear un origen de instalación para una instalación basada en red utilizando un árbol de instalación, que es un directorio que contiene el contenido extraído de la imagen ISO del DVD binario y un archivo válido .treeinfo. Se accede al origen de instalación a través de HTTP o HTTPS.

Requisitos previos

- Usted tiene acceso de nivel de administrador a un servidor con Red Hat Enterprise Linux 8, y este servidor está en la misma red que el sistema a ser instalado.

- Ha descargado una imagen binaria de DVD. Consulte Descarga de la imagen ISO de instalación en el documento Performing a standard RHEL installation para obtener más información.

- Ha creado un CD, DVD o dispositivo USB de arranque a partir del archivo de imagen. Consulte Creación de medios de instalación desde el documento Performing a standard RHEL installation para obtener más información.

- Ha verificado que su cortafuegos permite que el sistema que está instalando acceda al origen de la instalación remota. Consulte Puertos para la instalación basada en la red del documento Performing a standard RHEL installation para obtener más información.

Procedimiento

Instale el paquete

httpd:# yum install httpdAvisoSi la configuración de su servidor web Apache habilita la seguridad SSL, verifique que habilita solo el protocolo TLSv1 y deshabilita SSLv2 y SSLv3. Esto se debe a la vulnerabilidad POODLE SSL (CVE-2014-3566). Consulte https://access.redhat.com/solutions/1232413 para obtener más detalles.

ImportanteSi utiliza un servidor HTTPS con un certificado autofirmado, debe arrancar el programa de instalación con la opción

noverifyssl.- Copie la imagen ISO del DVD binario en el servidor HTTP(S).

Monte la imagen ISO del DVD binario, utilizando el comando

mount, en un directorio adecuado:# mkdir /mnt/rhel8-install/ # mount -o loop,ro -t iso9660 /image_directory/image.iso /mnt/rhel8-install/Sustituya /image_directory/image.iso por la ruta de acceso a la imagen ISO del DVD binario.

Copiar los archivos de la imagen montada a la raíz del servidor HTTP(S). Este comando crea el directorio

/var/www/html/rhel8-install/con el contenido de la imagen.# cp -r /mnt/rhel8-install/ /var/www/html/Este comando crea el directorio

/var/www/html/rhel8-install/con el contenido de la imagen. Tenga en cuenta que algunos métodos de copia pueden omitir el archivo.treeinfo, que es necesario para un origen de instalación válido. Si se ejecuta el comandocppara directorios enteros como se muestra en este procedimiento, se copiará.treeinfocorrectamente.Inicie el servicio

httpd:# systemctl start httpd.serviceEl árbol de instalación está ahora accesible y listo para ser utilizado como fuente de instalación.

NotaCuando configure el origen de la instalación, utilice

http://ohttps://como protocolo, el nombre de host del servidor o la dirección IP, y el directorio que contiene los archivos de la imagen ISO, en relación con la raíz del servidor HTTP. Por ejemplo, si utiliza HTTP, el nombre del servidor esmyserver.example.comy ha copiado los archivos de la imagen en/var/www/html/rhel8-install/, especifiquehttp://myserver.example.com/rhel8-install/como origen de la instalación.

Recursos adicionales

- Para más información sobre los servidores HTTP, consulte el documento Deploying different types of servers documento.

2.8.6. Creación de un origen de instalación mediante FTP

Siga los pasos de este procedimiento para crear un origen de instalación para una instalación basada en red utilizando un árbol de instalación, que es un directorio que contiene el contenido extraído de la imagen ISO del DVD binario y un archivo válido .treeinfo. Se accede al origen de la instalación a través de FTP.

Requisitos previos

- Usted tiene acceso de nivel de administrador a un servidor con Red Hat Enterprise Linux 8, y este servidor está en la misma red que el sistema a ser instalado.

- Ha descargado una imagen binaria de DVD. Consulte Descarga de la imagen ISO de instalación en el documento Performing a standard RHEL installation para obtener más información.

- Ha creado un CD, DVD o dispositivo USB de arranque a partir del archivo de imagen. Consulte Creación de medios de instalación desde el documento Performing a standard RHEL installation para obtener más información.

- Ha verificado que su cortafuegos permite que el sistema que está instalando acceda al origen de la instalación remota. Consulte Puertos para la instalación basada en la red del documento Performing a standard RHEL installation para obtener más información.

Procedimiento

Instale el paquete

vsftpdejecutando el siguiente comando como root:# yum install vsftpdAbra y edite el archivo de configuración

/etc/vsftpd/vsftpd.confen un editor de texto.-

Cambie la línea

anonymous_enable=NOporanonymous_enable=YES -

Cambie la línea

write_enable=YESporwrite_enable=NO. Añadir líneas

pasv_min_port=min_portypasv_max_port=max_port. Sustituya min_port y max_port por el rango de números de puerto utilizado por el servidor FTP en modo pasivo, por ejemplo10021y10031.Este paso puede ser necesario en entornos de red con varias configuraciones de firewall/NAT.

Opcionalmente, añada cambios personalizados a su configuración. Para conocer las opciones disponibles, consulte la página de manual vsftpd.conf(5). Este procedimiento asume que se utilizan las opciones por defecto.

AvisoSi ha configurado la seguridad SSL/TLS en su archivo

vsftpd.conf, asegúrese de habilitar sólo el protocolo TLSv1 y de desactivar SSLv2 y SSLv3. Esto se debe a la vulnerabilidad POODLE SSL (CVE-2014-3566). Consulte https://access.redhat.com/solutions/1234773 para obtener más detalles.

-

Cambie la línea

Configurar el cortafuegos del servidor.

Activa el cortafuegos:

# systemctl enable firewalld # systemctl start firewalldHabilite en su firewall el puerto FTP y el rango de puertos del paso anterior:

# firewall-cmd --add-port min_port-max_port/tcp --permanent # firewall-cmd --add-service ftp --permanent # firewall-cmd --reloadSustituya min_port-max_port por los números de puerto que introdujo en el archivo de configuración

/etc/vsftpd/vsftpd.conf.

- Copie la imagen ISO del DVD binario en el servidor FTP.

Monte la imagen ISO del DVD binario, utilizando el comando mount, en un directorio adecuado:

# mkdir /mnt/rhel8-install # mount -o loop,ro -t iso9660 /image-directory/image.iso /mnt/rhel8-installSustituya /image-directory/image.iso por la ruta de acceso a la imagen ISO del DVD binario.

Copie los archivos de la imagen montada a la raíz del servidor FTP:

# mkdir /var/ftp/rhel8-install # cp -r /mnt/rhel8-install/ /var/ftp/Este comando crea el directorio

/var/ftp/rhel8-install/con el contenido de la imagen. Tenga en cuenta que algunos métodos de copia pueden omitir el archivo.treeinfo, que es necesario para un origen de instalación válido. Si se ejecuta el comandocppara directorios enteros como se muestra en este procedimiento, se copiará.treeinfocorrectamente.Asegúrese de que el contexto SELinux y el modo de acceso correctos están establecidos en el contenido copiado:

# restorecon -r /var/ftp/rhel8-install # find /var/ftp/rhel8-install -type f -exec chmod 444 {} \; # find /var/ftp/rhel8-install -type d -exec chmod 755 {} \;Inicie el servicio

vsftpd:# systemctl start vsftpd.serviceSi el servicio estaba en marcha antes de cambiar el archivo

/etc/vsftpd/vsftpd.conf, reinicie el servicio para cargar el archivo editado:# systemctl restart vsftpd.serviceHabilite el servicio

vsftpdpara que se inicie durante el proceso de arranque:# systemctl enable vsftpdEl árbol de instalación está ahora accesible y listo para ser utilizado como fuente de instalación.

NotaCuando configure el origen de la instalación, utilice

ftp://como protocolo, el nombre del servidor o la dirección IP y el directorio en el que ha almacenado los archivos de la imagen ISO, en relación con la raíz del servidor FTP. Por ejemplo, si el nombre del servidor esmyserver.example.comy ha copiado los archivos de la imagen en/var/ftp/rhel8-install/, especifiqueftp://myserver.example.com/rhel8-install/como origen de la instalación.

Capítulo 3. Cómo empezar

Para comenzar con la instalación, primero revise el menú de arranque y las opciones de arranque disponibles. A continuación, en función de la elección que haga, proceda a arrancar la instalación.

3.1. Arranque de la instalación

Una vez que haya creado los medios de arranque, estará listo para arrancar la instalación de Red Hat Enterprise Linux.

3.1.2. Tipos de opciones de arranque

Hay dos tipos de opciones de arranque: las que tienen el signo igual \ "=", y las que no tienen el signo igual \ "=". Las opciones de arranque se añaden a la línea de comandos de arranque y las opciones múltiples deben estar separadas por un solo espacio. Las opciones de arranque que son específicas del programa de instalación siempre comienzan con inst.

- Opciones con un signo de igualdad \ "="

-

Debe especificar un valor para las opciones de arranque que utilizan el símbolo

=. Por ejemplo, la opcióninst.vncpassword=debe contener un valor, en este caso, una contraseña. La sintaxis correcta para este ejemplo esinst.vncpassword=password. - Opciones sin signo de igualdad "="

-

Esta opción de arranque no acepta ningún valor o parámetro. Por ejemplo, la opción

rd.live.checkobliga al programa de instalación a verificar el medio de instalación antes de iniciar la instalación. Si esta opción de arranque está presente, se realiza la verificación; si la opción de arranque no está presente, se omite la verificación.

3.1.3. Edición de las opciones de arranque

Esta sección contiene información sobre las diferentes formas en que puede editar las opciones de arranque desde el menú de arranque. El menú de arranque se abre después de arrancar el medio de instalación.

Editar el indicador boot: en la BIOS

Cuando se utiliza el indicador boot:, la primera opción debe especificar siempre el archivo de imagen del programa de instalación que se desea cargar. En la mayoría de los casos, puede especificar la imagen utilizando la palabra clave. Puede especificar opciones adicionales según sus necesidades.

Requisitos previos

- Has creado un medio de instalación de arranque (USB, CD o DVD).

- Ha arrancado la instalación desde el medio, y el menú de arranque de la instalación está abierto.

Procedimiento

- Con el menú de arranque abierto, pulse la tecla Esc de su teclado.

-

Ahora se puede acceder a la página

boot:. - Pulse la tecla Tab del teclado para mostrar los comandos de ayuda.

-

Pulse la tecla Enter de su teclado para iniciar la instalación con sus opciones. Para volver de la indicación

boot:al menú de arranque, reinicie el sistema y vuelva a arrancar desde el medio de instalación.

El prompt boot: también acepta las opciones del kernel dracut. Una lista de opciones está disponible en la página man de dracut.cmdline(7).

Editar la indicación >

Puede utilizar el indicador > para editar las opciones de arranque predefinidas. Por ejemplo, seleccione Test this media and install Red Hat Enterprise Linux 8.1 en el menú de arranque para mostrar un conjunto completo de opciones.

Este procedimiento es para sistemas AMD64 e Intel 64 basados en BIOS.

Requisitos previos

- Has creado un medio de instalación de arranque (USB, CD o DVD).

- Ha arrancado la instalación desde el medio, y el menú de arranque de la instalación está abierto.

Procedimiento

-

En el menú de arranque, seleccione una opción y pulse la tecla Tab del teclado. El prompt

>es accesible y muestra las opciones disponibles. -

Añada las opciones que necesite a la consulta

>. - Pulse la tecla Enter de su teclado para iniciar la instalación.

- Pulse la tecla Esc de su teclado para cancelar la edición y volver al menú de arranque.

Editar el menú de GRUB2

El menú GRUB2 está disponible en sistemas AMD64, Intel 64 y ARM de 64 bits basados en UEFI.

Requisitos previos

- Has creado un medio de instalación de arranque (USB, CD o DVD).

- Ha arrancado la instalación desde el medio, y el menú de arranque de la instalación está abierto.

Procedimiento

- En la ventana del menú de arranque, seleccione la opción deseada y pulse la tecla e de su teclado.

-

Mueva el cursor a la línea de comandos del kernel. En los sistemas UEFI, la línea de comandos del kernel comienza con

linuxefi. -

Mueve el cursor al final de la línea de comandos del kernel

linuxefi. -

Edite los parámetros según sea necesario. Por ejemplo, para configurar una o más interfaces de red, añada el parámetro

ip=al final de la línea de comandos del kernellinuxefi, seguido del valor requerido. - Cuando termine de editar, pulse Ctrl X en su teclado para iniciar la instalación con las opciones especificadas.

3.1.4. Arranque de la instalación desde un USB, CD o DVD

Siga los pasos de este procedimiento para arrancar la instalación de Red Hat Enterprise Linux utilizando un USB, CD o DVD. Los pasos siguientes son genéricos. Consulte la documentación del fabricante de su hardware para obtener instrucciones específicas.

Requisito previo

Ha creado un medio de instalación de arranque (USB, CD o DVD). Consulte Sección 2.7, “Creación de un medio de instalación de arranque” para obtener más información.

Procedimiento

- Apague el sistema en el que está instalando Red Hat Enterprise Linux.

- Desconecte las unidades del sistema.

- Encienda el sistema.

- Inserte el medio de instalación de arranque (USB, DVD o CD).

- Apague el sistema pero no retire el medio de arranque.

Encienda el sistema.

NotaEs posible que tenga que pulsar una tecla o combinación de teclas específica para arrancar desde el soporte o configurar el sistema básico de entrada/salida (BIOS) de su sistema para arrancar desde el soporte. Para más información, consulte la documentación que acompaña a su sistema.

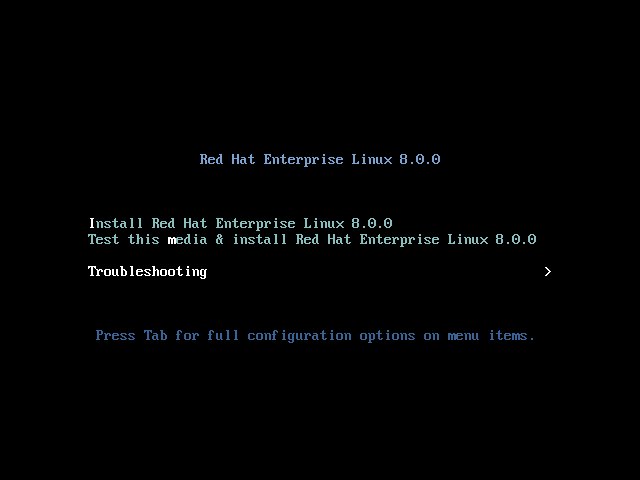

- La ventana Red Hat Enterprise Linux boot se abre y muestra información sobre una variedad de opciones de arranque disponibles.

Utilice las teclas de flecha de su teclado para seleccionar la opción de arranque que necesite y pulse Intro para seleccionar la opción de arranque. Se abre la ventana Welcome to Red Hat Enterprise Linux y puede instalar Red Hat Enterprise Linux utilizando la interfaz gráfica de usuario.

NotaEl programa de instalación se inicia automáticamente si no se realiza ninguna acción en la ventana de arranque en 60 segundos.

Opcionalmente, edite las opciones de arranque disponibles:

- UEFI-based systems: Pulse E para entrar en el modo de edición. Cambie la línea de comandos predefinida para añadir o eliminar opciones de arranque. Pulse Enter para confirmar su elección.

- BIOS-based systems: Pulse la tecla Tab de su teclado para entrar en el modo de edición. Cambie la línea de comandos predefinida para añadir o eliminar opciones de arranque. Pulse Enter para confirmar su elección.

3.1.5. Arranque de la instalación desde una red utilizando PXE

Cuando se instala Red Hat Enterprise Linux en un gran número de sistemas simultáneamente, el mejor enfoque es arrancar desde un servidor PXE e instalar desde una fuente en una ubicación de red compartida. Siga los pasos de este procedimiento para arrancar la instalación de Red Hat Enterprise Linux desde una red utilizando PXE.

Para arrancar el proceso de instalación desde una red utilizando PXE, debe utilizar una conexión de red física, por ejemplo, Ethernet. No se puede arrancar el proceso de instalación con una conexión inalámbrica.

Requisitos previos

- Ha configurado un servidor TFTP y hay una interfaz de red en su sistema que soporta PXE. Consulte Additional resources para obtener más información.

- Ha configurado su sistema para arrancar desde la interfaz de red. Esta opción está en la BIOS, y puede ser etiquetada como Network Boot o Boot Services.

- Ha comprobado que la BIOS está configurada para arrancar desde la interfaz de red especificada. Algunos sistemas BIOS especifican la interfaz de red como un posible dispositivo de arranque, pero no son compatibles con el estándar PXE. Consulte la documentación de su hardware para obtener más información. Cuando haya habilitado correctamente el arranque PXE, el sistema puede arrancar el programa de instalación de Red Hat Enterprise Linux sin ningún otro medio.

Procedimiento

- Compruebe que el cable de red está conectado. El indicador luminoso de enlace de la toma de red debe estar iluminado, aunque el ordenador no esté encendido.

Encienda el sistema.

Dependiendo de su hardware, se puede mostrar alguna información de configuración de red y de diagnóstico antes de que su sistema se conecte a un servidor PXE. Cuando se conecta, se muestra un menú según la configuración del servidor PXE.

Pulse la tecla numérica que corresponde a la opción que desea.

NotaEn algunos casos, las opciones de arranque no se muestran. Si esto ocurre, pulse la tecla Enter del teclado o espere a que se abra la ventana de arranque.

La ventana Red Hat Enterprise Linux boot se abre y muestra información sobre una variedad de opciones de arranque disponibles.

Utilice las teclas de flecha de su teclado para seleccionar la opción de arranque que necesite y pulse Intro para seleccionar la opción de arranque. Se abre la ventana Welcome to Red Hat Enterprise Linux y puede instalar Red Hat Enterprise Linux utilizando la interfaz gráfica de usuario.

NotaEl programa de instalación se inicia automáticamente si no se realiza ninguna acción en la ventana de arranque en 60 segundos.

Opcionalmente, edite las opciones de arranque disponibles:

- UEFI-based systems: Pulse E para entrar en el modo de edición. Cambie la línea de comandos predefinida para añadir o eliminar opciones de arranque. Pulse Enter para confirmar su elección.

- BIOS-based systems: Pulse la tecla Tab de su teclado para entrar en el modo de edición. Cambie la línea de comandos predefinida para añadir o eliminar opciones de arranque. Pulse Enter para confirmar su elección.

Recursos adicionales

- Para información sobre cómo preparar la instalación de Red Hat Enterprise Linux desde la red usando PXE, vea el Performing an advanced RHEL installation documento.

- Consulte la Referencia de opciones de arranque para obtener más información sobre la lista de opciones de arranque disponibles que puede utilizar en la línea de comandos de arranque.

3.2. Instalación de RHEL mediante una imagen ISO desde el Portal del Cliente

Utilice este procedimiento para instalar RHEL utilizando una imagen ISO de DVD binario que haya descargado del Portal del Cliente. Los pasos proporcionan instrucciones para seguir el programa de instalación de RHEL.

Cuando se realiza una instalación GUI utilizando el archivo de imagen ISO de DVD binario, una condición de carrera en el instalador puede a veces impedir que la instalación continúe hasta que se registre el sistema utilizando la función Conectar con Red Hat. Para más información, vea BZ#1823578 en la sección de Problemas Conocidos del RHEL 8.2 Release Notes documento.

Requisitos previos

- Ha descargado el archivo de imagen ISO de DVD binario desde el Portal del Cliente.

- Ha creado un medio de instalación de arranque.

- Ha arrancado el programa de instalación y se muestra el menú de arranque.

Procedimiento

- En el menú de arranque, seleccione Install Red Hat Enterprise Linux 8.x, y pulse Enter en su teclado.

- En la ventana Welcome to Red Hat Enterprise Linux 8.x, seleccione su idioma y ubicación, y haga clic en . La ventana Installation Summary se abre y muestra los valores por defecto para cada ajuste.

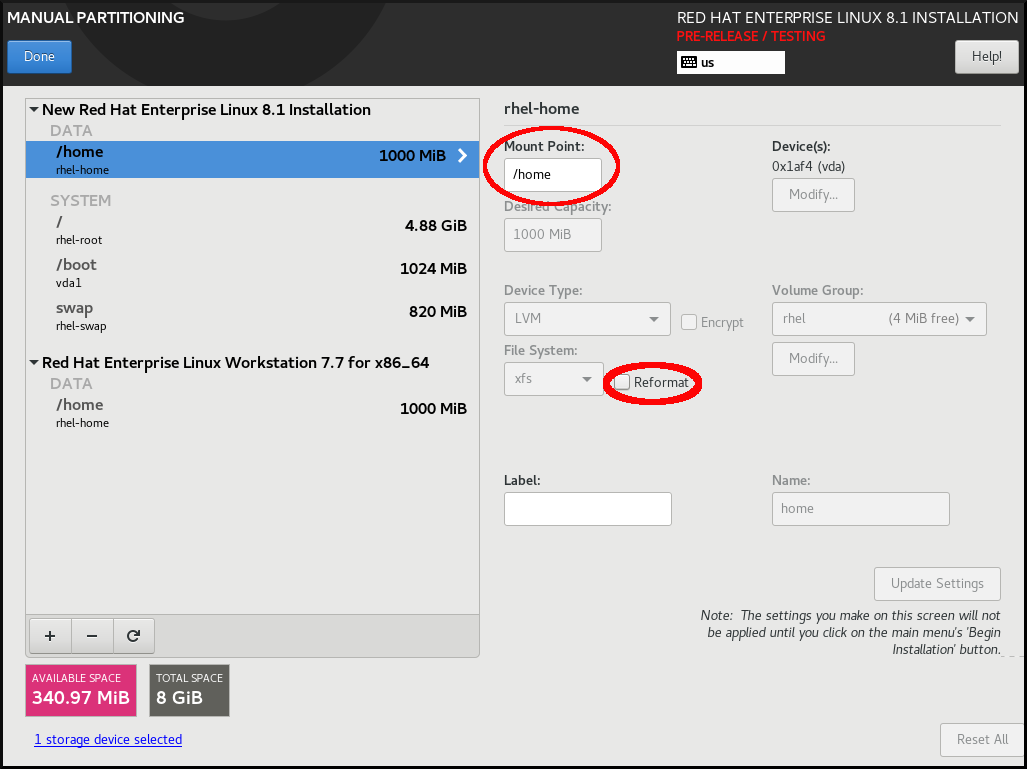

- Seleccione System > Installation Destination, y en el panel Local Standard Disks, seleccione el disco de destino y luego haga clic en . Se seleccionan los ajustes por defecto para la configuración del almacenamiento. Para obtener más información sobre la personalización de la configuración de almacenamiento, consulte Sección 4.4, “Configuración de las opciones de software”, Sección 4.5, “Configuración de los dispositivos de almacenamiento”, Sección 4.6, “Configuración de la partición manual”.

- Seleccione System > Network & Host Name. Se abre la ventana Network and Hostname.

- En la ventana Network and Hostname, cambie el interruptor de Ethernet a ON, y luego haga clic en . El instalador se conecta a una red disponible y configura los dispositivos disponibles en la red. Si es necesario, de la lista de redes disponibles, puede elegir una red deseada y configurar los dispositivos que están disponibles en esa red. Para obtener más información sobre la configuración de una red o de dispositivos de red, consulte Sección 4.3.3, “Configurar las opciones de red y de nombre de host”.

- Seleccione User Settings > Root Password. Se abre la ventana Root Password.

- En la ventana Root Password, escriba la contraseña que desea establecer para la cuenta de root y, a continuación, haga clic en . La contraseña de root es necesaria para finalizar el proceso de instalación y para acceder a la cuenta de usuario de administrador del sistema. Para más detalles sobre los requisitos y recomendaciones para crear una contraseña, consulte Sección 4.7, “Configurar una contraseña de root”.

- Opcional: Seleccione User Settings > User Creation para crear una cuenta de usuario para completar el proceso de instalación. En lugar de la cuenta raíz, puede utilizar esta cuenta de usuario para realizar cualquier tarea administrativa del sistema.

En la ventana Create User, realice lo siguiente, y luego haga clic en .

- Escriba un nombre y un nombre de usuario para la cuenta que desea crear.

- Seleccione las casillas Make this user administrator y Require a password to use this account. El programa de instalación añade el usuario al grupo de la rueda y crea una cuenta de usuario protegida por contraseña con la configuración predeterminada. Se recomienda crear una cuenta de usuario administrativa protegida con contraseña. Para más información sobre cómo editar la configuración por defecto de una cuenta de usuario, consulte Sección 4.8, “Crear una cuenta de usuario”.

- Haga clic en para comenzar la instalación.

- Cuando el proceso de instalación haya finalizado, haga clic en para reiniciar el sistema.

- Desde la ventana Initial Setup, acepte el acuerdo de licencia y registre su sistema.

Recursos adicionales

- Para saber más sobre cómo preparar su instalación, consulte Performing a standard RHEL installation para más información.

- Para obtener más información sobre cómo personalizar su red, conectarse a Red Hat, propósito del sistema, destino de la instalación, KDUMP y política de seguridad, consulte Performing a standard RHEL installation para más información.

- Para saber más sobre cómo completar la instalación, consulte Performing a standard RHEL installation para más información.

- Para saber más sobre cómo registrar su sistema, consulte Performing a standard RHEL installation para más información.

3.3. Registro e instalación de RHEL desde la CDN mediante la GUI

Esta sección contiene información sobre cómo registrar su sistema, adjuntar suscripciones a RHEL e instalar RHEL desde la Red Hat Content Delivery Network (CDN) utilizando la GUI.

3.3.1. Qué es la Red de Entrega de Contenidos

La Red de Entrega de Contenidos (CDN) de Red Hat, disponible en cdn.redhat.com, es una serie de servidores web estáticos distribuidos geográficamente que contienen contenidos y erratas que son consumidos por los sistemas. El contenido puede ser consumido directamente, por ejemplo, utilizando un sistema registrado en Red Hat Subscription Management. La CDN está protegida por la autenticación de certificados x.509 para garantizar que sólo los usuarios válidos tengan acceso. Cuando un sistema se registra en Red Hat Subscription Management, las suscripciones adjuntas regulan el subconjunto de la CDN al que puede acceder el sistema.

El registro y la instalación de RHEL desde la CDN proporciona las siguientes ventajas:

- El método de instalación CDN admite los archivos de imagen Boot ISO y Binary DVD ISO. Sin embargo, se recomienda el uso del archivo de imagen Boot ISO más pequeño, ya que consume menos espacio que el archivo de imagen Binary DVD ISO más grande.

- El CDN utiliza los últimos paquetes, lo que da como resultado un sistema totalmente actualizado justo después de la instalación. No es necesario instalar las actualizaciones de los paquetes inmediatamente después de la instalación, como suele ocurrir cuando se utiliza el archivo de imagen ISO del DVD binario.

- Soporte integrado para conectar con Red Hat Insights y habilitar System Purpose.

El registro y la instalación de RHEL desde la CDN están soportados por la GUI y Kickstart. Para obtener información sobre cómo registrar e instalar RHEL mediante la GUI, consulte el Performing a standard RHEL installation documento. Para obtener información sobre cómo registrar e instalar RHEL mediante Kickstart, consulte el documento Performing an advanced RHEL installation documento.

3.3.2. Registro e instalación de RHEL desde la CDN

Utilice este procedimiento para registrar su sistema, adjuntar suscripciones a RHEL e instalar RHEL desde la Red Hat Content Delivery Network (CDN) utilizando la GUI.

La función CDN es compatible con los archivos de imagen Boot ISO y Binary DVD ISO. Sin embargo, se recomienda utilizar el archivo de imagen Boot ISO, ya que el origen de la instalación es por defecto CDN para el archivo de imagen Boot ISO.

Requisitos previos

- Su sistema está conectado a una red que puede acceder a la CDN.

- Ha descargado el archivo de imagen Boot ISO desde el Portal del Cliente.

- Ha creado un medio de instalación de arranque.

- Ha arrancado el programa de instalación y se muestra el menú de arranque. Tenga en cuenta que el repositorio de instalación utilizado tras el registro del sistema depende de cómo se haya arrancado el sistema.

Procedimiento

- En el menú de arranque, seleccione Install Red Hat Enterprise Linux 8.x, y pulse Enter en su teclado.

- En la ventana Welcome to Red Hat Enterprise Linux 8.x, seleccione su idioma y ubicación, y haga clic en . La ventana Installation Summary se abre y muestra los valores por defecto para cada ajuste.

- Seleccione System > Installation Destination, y en el panel Local Standard Disks, seleccione el disco de destino y luego haga clic en . Se seleccionan los ajustes por defecto para la configuración del almacenamiento. Para obtener más información sobre la personalización de la configuración de almacenamiento, consulte Sección 4.4, “Configuración de las opciones de software”, Sección 4.5, “Configuración de los dispositivos de almacenamiento”, Sección 4.6, “Configuración de la partición manual”.

- Seleccione System > Network & Host Name. Se abre la ventana Network and Hostname.

- En la ventana Network and Hostname, cambie el interruptor de Ethernet a ON, y luego haga clic en . El instalador se conecta a una red disponible y configura los dispositivos disponibles en la red. Si es necesario, de la lista de redes disponibles, puede elegir una red deseada y configurar los dispositivos que están disponibles en esa red. Para obtener más información sobre la configuración de una red o de dispositivos de red, consulte Sección 4.3.3, “Configurar las opciones de red y de nombre de host”.

- Seleccione Software > Connect to Red Hat. Se abre la ventana Connect to Red Hat.

En la ventana Connect to Red Hat, realice los siguientes pasos:

Seleccione el método Authentication, y proporcione los detalles basados en el método que seleccione.

Para Account método de autenticación: Introduzca su nombre de usuario y contraseña del Portal del Cliente de Red Hat.

Para el método de autenticación Activation Key: Introduzca el ID de su organización y la clave de activación. Puede introducir más de una clave de activación, separadas por una coma, siempre que las claves de activación estén registradas en su suscripción.

Marque la casilla Set System Purpose y, a continuación, seleccione las opciones Role, SLA y Usage de las listas desplegables correspondientes.

Con el Propósito del sistema puede registrar el uso previsto de un sistema Red Hat Enterprise Linux 8 y asegurarse de que el servidor de asignación de derechos asigne automáticamente la suscripción más adecuada a su sistema.

La casilla Connect to Red Hat Insights está activada por defecto. Desactive la casilla si no desea conectarse a Red Hat Insights.

Red Hat Insights es una oferta de software como servicio (SaaS) que proporciona un análisis continuo y en profundidad de los sistemas registrados basados en Red Hat para identificar de forma proactiva las amenazas a la seguridad, el rendimiento y la estabilidad en entornos físicos, virtuales y de nube, así como en implementaciones de contenedores.

Opcionalmente, expanda Options, y seleccione el tipo de comunicación de red.

- Seleccione la casilla Use HTTP proxy si su entorno de red sólo permite el acceso externo a Internet o accede a los servidores de contenido a través de un proxy HTTP.

Si está ejecutando el Servidor Satélite o realizando pruebas internas, seleccione las casillas de verificación Custom server URL y Custom base URL e introduzca los datos necesarios.

El campo Custom server URL no requiere el protocolo HTTP, por ejemplo

nameofhost.com. Sin embargo, el campo Custom base URL requiere el protocolo HTTP. Para cambiar el Custom base URL después del registro, debe anular el registro, proporcionar los nuevos datos y volver a registrarse.

Haga clic en . Cuando el sistema se registra con éxito y se adjuntan las suscripciones, la ventana Connect to Red Hat muestra los detalles de la suscripción adjunta.

Dependiendo de la cantidad de suscripciones, el proceso de registro y fijación puede tardar hasta un minuto en completarse.

Haga clic en .

En Connect to Red Hat aparece un mensaje de Registered.

- Seleccione User Settings > Root Password. Se abre la ventana Root Password.

- En la ventana Root Password, escriba la contraseña que desea establecer para la cuenta de root y, a continuación, haga clic en . La contraseña de root es necesaria para finalizar el proceso de instalación y para acceder a la cuenta de usuario de administrador del sistema. Para más detalles sobre los requisitos y recomendaciones para crear una contraseña, consulte Sección 4.7, “Configurar una contraseña de root”.

- Opcional: Seleccione User Settings > User Creation para crear una cuenta de usuario para completar el proceso de instalación. En lugar de la cuenta raíz, puede utilizar esta cuenta de usuario para realizar cualquier tarea administrativa del sistema.

En la ventana Create User, realice lo siguiente, y luego haga clic en .

- Escriba un nombre y un nombre de usuario para la cuenta que desea crear.

- Seleccione las casillas Make this user administrator y Require a password to use this account. El programa de instalación añade el usuario al grupo de la rueda y crea una cuenta de usuario protegida por contraseña con la configuración predeterminada. Se recomienda crear una cuenta de usuario administrativa protegida con contraseña. Para más información sobre cómo editar la configuración por defecto de una cuenta de usuario, consulte Sección 4.8, “Crear una cuenta de usuario”.

- Haga clic en para comenzar la instalación.

- Cuando el proceso de instalación haya finalizado, haga clic en para reiniciar el sistema.

- Desde la ventana Initial Setup, acepte el acuerdo de licencia y registre su sistema.

Recursos adicionales

- Para saber más sobre cómo preparar su instalación, consulte Performing a standard RHEL installation para más información.

- Para saber más sobre cómo personalizar la red, la conexión a Red Hat, el propósito del sistema, el destino de la instalación, KDUMP y la política de seguridad, consulte Performing a standard RHEL installation para más información.

- Para obtener información sobre Red Hat Insights, consulte la página Red Hat Insights product documentation.

- Para obtener información sobre las claves de activación, consulte el Understanding Activation Keys capítulo del documento Using Red Hat Subscription Management.

- Para obtener información sobre cómo configurar un proxy HTTP para Subscription Manager, consulte el Using an HTTP proxy capítulo del documento Using and Configuring Red Hat Subscription Manager.

3.3.2.1. Repositorio de fuentes de instalación tras el registro del sistema

El repositorio de origen de la instalación utilizado tras el registro del sistema depende de cómo se haya arrancado el sistema.

- Sistema arrancado desde el archivo de imagen ISO de arranque o el DVD binario

-

Si ha arrancado la instalación de RHEL utilizando el archivo de imagen

Boot ISOoBinary DVD ISOcon los parámetros de arranque por defecto, el programa de instalación cambia automáticamente el repositorio de origen de la instalación al CDN después del registro. - El sistema arrancó con el parámetro de arranque

inst.repo=<URL> -

Si arrancó la instalación de RHEL con el parámetro de arranque

inst.repo=<URL>, el programa de instalación no cambia automáticamente el repositorio de origen de la instalación a la CDN después del registro. Si desea utilizar la CDN para instalar RHEL, debe cambiar manualmente el repositorio de origen de la instalación a la CDN seleccionando la opción Red Hat CDN en la ventana Installation Source de la instalación gráfica. Si no se cambia manualmente a la CDN, el programa de instalación instala los paquetes desde el repositorio especificado en la línea de comandos del kernel.

-

Puede cambiar el repositorio de origen de la instalación al CDN utilizando el comando Kickstart

rhsmsólo si no especifica un origen de instalación utilizandoinst.repo=en la línea de comandos del kernel o el comandourlen el archivo Kickstart. Debe utilizarinst.stage2=<URL>en la línea de comandos del kernel para obtener la imagen de instalación, pero sin especificar el origen de la instalación. -

Una URL de origen de instalación especificada mediante una opción de arranque o incluida en un archivo Kickstart tiene prioridad sobre la CDN, incluso si el archivo Kickstart contiene el comando

rhsmcon credenciales válidas. El sistema se registra, pero se instala desde la URL de origen de la instalación. Esto garantiza que los procesos de instalación anteriores funcionen con normalidad.

3.3.3. Verificar el registro de su sistema desde el CDN

Utilice este procedimiento para verificar que su sistema está registrado en el CDN utilizando la GUI.

not Sólo puede verificar su registro desde la CDN si ha hecho clic en el botón Begin Installation de la ventana Installation Summary. Una vez que haya hecho clic en el botón Begin Installation, no podrá volver a la ventana de resumen de la instalación para verificar su registro.

Requisito previo

- Ha completado el proceso de registro tal y como se documenta en Sección 3.3.2, “Registro e instalación de RHEL desde la CDN” y Registered aparece bajo Connect to Red Hat en la ventana Installation Summary.

Procedimiento

- En la ventana Installation Summary, seleccione Connect to Red Hat.

La ventana se abre y muestra un resumen del registro:

- Método

- Se muestra el nombre de la cuenta registrada o las claves de activación.

- Objetivo del sistema

- Si se establece, se muestra el rol, el SLA y los detalles de uso.

- Información

- Si se activa, se muestran los detalles de Insights.

- Número de suscripciones

- Se muestra el número de suscripciones adjuntas.

- Compruebe que el resumen del registro coincide con los datos introducidos.

3.3.4. Cómo anular el registro de su sistema en la CDN

Utilice este procedimiento para anular el registro de su sistema de la CDN utilizando la GUI.

- Puede anular el registro de la CDN si ha hecho clic en el botón la instalación de la ventana Installation Summary en not. Una vez que haya hecho clic en el botón la instalación, no podrá volver a la ventana Resumen de la instalación para anular el registro.

Al anular el registro, el programa de instalación pasa al primer repositorio disponible, en el siguiente orden:

- La URL utilizada en el parámetro de arranque inst.repo=<URL> en la línea de comandos del kernel.

- Un repositorio detectado automáticamente en el medio de instalación (USB o DVD).

Requisito previo

- Ha completado el proceso de registro tal y como se documenta en Sección 3.3.2, “Registro e instalación de RHEL desde la CDN” y Registered aparece bajo Connect to Red Hat en la ventana Installation Summary.

Procedimiento

- En la ventana Installation Summary, seleccione Connect to Red Hat.

La ventana Connect to Red Hat se abre y muestra un resumen del registro:

- Método

- Se muestra el nombre de la cuenta registrada o las claves de activación utilizadas.

- Objetivo del sistema

- Si se establece, se muestra el rol, el SLA y los detalles de uso.

- Información

- Si se activa, se muestran los detalles de Insights.

- Número de suscripciones

- Se muestra el número de suscripciones adjuntas.

- Haga clic en para eliminar el registro del CDN. Los detalles del registro original se muestran con un mensaje de Not registered que aparece en la parte media inferior de la ventana.

- Haga clic en para volver a la ventana Installation Summary.

- Connect to Red Hat muestra un mensaje Not registered, y Software Selection muestra un mensaje Red Hat CDN requires registration.

Después de anular el registro, es posible volver a registrar el sistema. Haga clic en Connect to Red Hat. Se rellenan los datos introducidos anteriormente. Edite los detalles originales o actualice los campos en función de la cuenta, el propósito y la conexión. Haga clic en para finalizar.

3.4. Completar la instalación

Espere a que se complete la instalación. Puede tardar unos minutos.

Una vez finalizada la instalación, retire cualquier medio de instalación si no se expulsa automáticamente al reiniciar.

Red Hat Enterprise Linux 8 se inicia después de que la secuencia normal de encendido de su sistema se haya completado. Si su sistema fue instalado en una estación de trabajo con el sistema X Window, se lanzan aplicaciones para configurar su sistema. Estas aplicaciones le guían a través de la configuración inicial y puede establecer la hora y la fecha de su sistema, registrar su sistema con Red Hat, etc. Si el sistema X Window no está instalado, se mostrará un prompt login:.

Para saber cómo completar la configuración inicial, el registro y la seguridad del sistema, consulte la sección Cómo completar las tareas posteriores a la instalación del documento Performing a standard RHEL installation.

Capítulo 4. Personalización de la instalación

Al instalar Red Hat Enterprise Linux, puede personalizar la ubicación, el software y los ajustes y parámetros del sistema, utilizando la ventana Installation Summary.

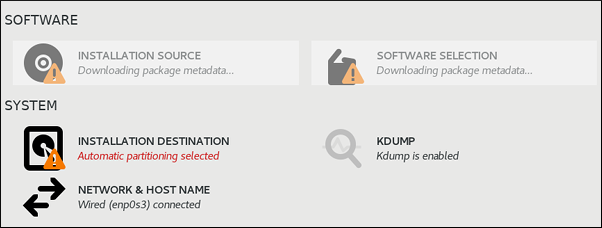

La ventana Installation Summary contiene las siguientes categorías:

- LOCALIZATION: Puede configurar el teclado, el soporte de idioma y la fecha y hora.

- SOFTWARE: Puede configurar la Conexión a Red Hat, la Fuente de Instalación y la Selección de Software.

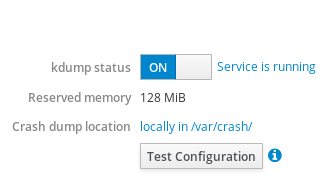

- SYSTEM: Puede configurar el destino de la instalación, el KDUMP, el nombre de la red y del host, y la política de seguridad.

- USER SETTINGS: Puede configurar una contraseña de root para acceder a la cuenta de administrador que se utiliza para las tareas de administración del sistema, y crear una cuenta de usuario para acceder al sistema.

Una categoría tiene un estado diferente según el lugar donde se encuentre en el programa de instalación.

| Estado de la categoría | Estado | Descripción |

|---|---|---|

| Warning symbol type 1 | Triángulo amarillo con un signo de exclamación y texto rojo | Requiere atención antes de la instalación. Por ejemplo, la red & Nombre de host requiere atención antes de poder registrarse y descargar desde la red de entrega de contenidos (CDN). |

| Warning symbol type 2 | En gris y con un símbolo de advertencia (triángulo amarillo con un signo de exclamación) | El programa de instalación está configurando una categoría y debe esperar a que termine antes de acceder a la ventana. |

En la parte inferior de la ventana Installation Summary aparece un mensaje de advertencia y el botón Begin Installation se desactiva hasta que se configuren todas las categorías necesarias.

Esta sección contiene información sobre la personalización de su instalación de Red Hat Enterprise Linux utilizando la interfaz gráfica de usuario (GUI). La GUI es el método preferido para instalar Red Hat Enterprise Linux cuando arranca el sistema desde un CD, DVD o unidad flash USB, o desde una red usando PXE.

Puede haber alguna variación entre la ayuda en línea y el contenido que se publica en el Portal del Cliente. Para las últimas actualizaciones, consulte el contenido de la instalación en el Portal del Cliente.

4.1. Configuración de los ajustes de idioma y ubicación

El programa de instalación utiliza el idioma que ha seleccionado durante la instalación.

Requisitos previos

- Has creado un medio de instalación.

- Ha especificado una fuente de instalación si está utilizando el archivo de imagen Boot ISO.

- Has arrancado la instalación.

Procedimiento

En el panel izquierdo de la ventana Welcome to Red Hat Enterprise Linux, seleccione un idioma. Alternativamente, escriba su idioma preferido en el campo Search.

NotaUn idioma está preseleccionado por defecto. Si se configura el acceso a la red, es decir, si se arranca desde un servidor de red en lugar de un medio local, el idioma preseleccionado viene determinado por la función de detección automática de ubicación del módulo GeoIP. Si utilizó la opción

inst.lang=en la línea de comandos de arranque o en la configuración de su servidor PXE, entonces se selecciona el idioma que defina con la opción de arranque.- En el panel derecho de la ventana Welcome to Red Hat Enterprise Linux, seleccione una ubicación específica para su región.

Haga clic en para pasar a la ventana Capítulo 4, Personalización de la instalación.

ImportanteSi está instalando una versión preliminar de Red Hat Enterprise Linux, se mostrará un mensaje de advertencia sobre el estado preliminar del medio de instalación. Haga clic en para seguir con la instalación, o en para abandonar la instalación y reiniciar el sistema.

Recursos adicionales

Para obtener información sobre cómo cambiar la configuración de idioma y ubicación durante el programa de instalación, consulte Sección 4.2, “Configuración de las opciones de localización”

4.2. Configuración de las opciones de localización

Esta sección contiene información sobre la configuración del teclado, la compatibilidad con el idioma y la configuración de la fecha y la hora.

Si utiliza una disposición que no acepta caracteres latinos, como Russian, añada la disposición English (United States) y configure una combinación de teclado para cambiar entre las dos disposiciones. Si selecciona una disposición que no tiene caracteres latinos, es posible que no pueda introducir una contraseña válida de root ni las credenciales de usuario más adelante en el proceso de instalación. Esto podría impedirle completar la instalación.

4.2.1. Configurar el teclado, el idioma y la hora y la fecha

Los ajustes de teclado, idioma y fecha y hora están configurados por defecto como parte de Sección 4.1, “Configuración de los ajustes de idioma y ubicación”. Para cambiar cualquiera de las configuraciones, complete los siguientes pasos, de lo contrario proceda a Sección 4.4, “Configuración de las opciones de software”.

Procedimiento: Configurar los ajustes del teclado

En la ventana Installation Summary, haga clic en Keyboard. El diseño por defecto depende de la opción seleccionada en Sección 4.1, “Configuración de los ajustes de idioma y ubicación”.

- Haga clic en para abrir la ventana Add a Keyboard Layout y cambiar de diseño.

- Seleccione un diseño navegando por la lista o utilice el campo Search.

- Seleccione el diseño deseado y haga clic en . El nuevo diseño aparece debajo del diseño por defecto.

- Haga clic en para configurar opcionalmente un conmutador de teclado que puede utilizar para alternar entre las disposiciones disponibles. Se abre la ventana Layout Switching Options.

Para configurar las combinaciones de teclas para la conmutación, seleccione una o más combinaciones de teclas y haga clic en para confirmar su selección.

NotaCuando seleccione un diseño, haga clic en el botón Keyboard para abrir un nuevo cuadro de diálogo que muestra una representación visual del diseño seleccionado.

- Haga clic en para aplicar la configuración y volver a Capítulo 4, Personalización de la instalación.

Procedimiento: Configurar los ajustes de idioma

En la ventana Installation Summary, haga clic en Language Support. Se abre la ventana Language Support. En el panel izquierdo se enumeran los grupos de idiomas disponibles. Si se ha configurado al menos un idioma de un grupo, se muestra una marca de verificación y se resalta el idioma admitido.

- En el panel izquierdo, haga clic en un grupo para seleccionar otros idiomas y, en el panel derecho, seleccione las opciones regionales. Repita este proceso para los idiomas que necesite.

- Haga clic en para aplicar los cambios y volver a Capítulo 4, Personalización de la instalación.

Procedimiento: Configurar los ajustes de fecha y hora

En la ventana Installation Summary, haga clic en Time & Date. Se abre la ventana Time & Date.

NotaLos ajustes de Time & Date están configurados por defecto en función de los ajustes seleccionados en Sección 4.1, “Configuración de los ajustes de idioma y ubicación”.

La lista de ciudades y regiones procede de la base de datos de zonas horarias (