Hosted Control Plane

OpenShift Container Platform で Hosted Control Plane を使用する

概要

第1章 Hosted Control Plane のリリースノート

リリースノートには、新機能、非推奨機能、変更、既知の問題に関する情報が記載されています。

1.1. OpenShift Container Platform 4.19 用の Hosted Control Plane のリリースノート

このリリースでは、OpenShift Container Platform 4.19 用の Hosted Control Plane が利用可能になりました。OpenShift Container Platform 4.19 用の Hosted Control Plane は、multicluster engine for Kubernetes Operator バージョン 2.9 をサポートしています。

1.1.1. 新機能および機能拡張

1.1.1.1. カスタム DNS 名の定義

クラスター管理者は、ホステッドクラスターのカスタム DNS 名を定義して、DNS 名の管理および使用方法の柔軟性を高めることができるようになりました。詳細は、カスタム DNS 名の定義 を参照してください。

1.1.1.2. ホステッドクラスターの AWS タグの追加または更新

クラスター管理者は、さまざまな種類のリソースに対して Amazon Web Services (AWS) タグを追加または更新できます。詳細は、ホステッドクラスターの AWS タグの追加または更新 を参照してください。

1.1.1.3. OADP を使用したホステッドクラスターの自動障害復旧

ベアメタルまたは Amazon Web Services (AWS) プラットフォームでは、OpenShift API for Data Protection (OADP) を使用して、ホステッドクラスターの障害復旧を自動化できます。詳細は、OADP を使用したホステッドクラスターの自動障害復旧 を参照してください。

1.1.1.4. ベアメタルプラットフォーム上のホステッドクラスターの障害復旧

ベアメタルプラットフォーム上のホステッドクラスターの場合、OADP を使用して、データプレーンとコントロールプレーンのワークロードのバックアップや、同じ管理クラスターまたは新しい管理クラスターへの復元などの障害復旧タスクを完了できます。詳細は、OADP を使用したホステッドクラスターの障害復旧 を参照してください。

1.1.1.5. Red Hat OpenStack Platform (RHOSP) 17.1 上の Hosted Control Plane (テクノロジープレビュー)

RHOSP 17.1 上の Hosted Control Plane がテクノロジープレビュー機能としてサポートされるようになりました。

詳細は、OpenStack での Hosted Control Plane のデプロイ を参照してください。

1.1.1.6. AWS でのノードプール容量ブロックの設定

Amazon Web Services (AWS) 上の Hosted Control Plane のノードプール容量ブロックを設定できるようになりました。詳細は、AWS でのノードプール容量ブロックの設定 を参照してください。

1.1.2. バグ修正

以前は、管理 OpenShift クラスター内の IDMS または ICSP で registry.redhat.io または registry.redhat.io/redhat を参照するソースが定義されており、ミラーレジストリーに必要な OLM カタログイメージが含まれていない場合、不正なイメージプルが原因で

HostedClusterリソースのプロビジョニングが停止していました。その結果、HostedClusterリソースはデプロイされず、ブロックされたままになり、ミラーレジストリーから重要なカタログイメージを取得できませんでした。このリリースでは、認可エラーのために必要なイメージをプルできない場合、プロビジョニングが明示的に失敗するようになりました。レジストリーのオーバーライドのロジックが改善され、OLM CatalogSource イメージの解決時に registry.redhat.io などのレジストリーのルートでのマッチングが可能になりました。レジストリーのオーバーライドによって正常なイメージが得られなかった場合に、元の

ImageReferenceを使用するためのフォールバックメカニズムも導入されています。その結果、ミラーレジストリーに必要な OLM カタログイメージが不足しているシナリオでも、システムが適切な場合に元のソースからプルするように正しくフォールバックするため、

HostedClusterリソースを正常にデプロイできます。(OCPBUGS-56492)- 以前は、コントロールプレーンコントローラーは機能セットに対して正しい CVO マニフェストを適切に選択していませんでした。その結果、機能セットの間違った CVO マニフェストがホストされたクラスターにデプロイされた可能性がありました。実際には、CVO マニフェストは機能セット間で異なることはなかったため、この問題は実際には影響を与えませんでした。このリリースでは、コントロールプレーンコントローラーが、機能セットに対して正しい CVO マニフェストを適切に選択するようになりました。その結果、機能セットの正しい CVO マニフェストがホステッドクラスターに展開されます。(OCPBUGS-44438)

-

以前は、カスタム CA によって署名された証明書を提供する

HostedClusterリソースにセキュアプロキシーを設定すると、その CA はノードの初期 Ignition 設定に含まれていませんでした。その結果、Ignition に失敗したためノードは起動しませんでした。このリリースでは、プロキシーの信頼された CA を初期 Ignition 設定に含めることで問題が修正され、ノードのブートと Ignition が成功するようになりました。(OCPBUGS-56896) - 以前は、管理クラスターの IDMS または ICSP リソースが、ユーザーがイメージ置き換え用のミラーまたはソースとしてルートレジストリー名のみを指定する可能性があることを考慮せずに処理されていました。その結果、ルートレジストリー名のみを使用する IDMS または ICSP エントリーが期待どおりに動作しませんでした。このリリースでは、ミラーの置き換えロジックが、ルートレジストリー名のみが指定されているケースを正しく処理するようになりました。その結果、問題が発生しなくなり、ルートレジストリーミラーの置き換えがサポートされるようになりました。(OCPBUGS-55693)

-

以前は、OADP プラグインは間違った namespace で

DataUploadオブジェクトを検索していました。その結果、バックアッププロセスは無期限に停止しました。このリリースでは、プラグインはバックアップオブジェクトのソース namespace を使用するため、この問題は発生しなくなりました。(OCPBUGS-55469) -

以前は、ユーザーが

hc.spec.configuration.apiServer.servingCerts.namedCertificatesフィールドに追加したカスタム証明書の SAN が、Kubernetes Agent Server (KAS) のhc.spec.services.servicePublishingStrategyフィールドに設定されたホスト名と競合していました。その結果、KAS 証明書は新しいペイロードを生成するための証明書のセットに追加されず、HostedClusterリソースに参加しようとした新しいノードでは証明書の検証に問題が発生しました。このリリースでは、早期に失敗してユーザーに問題について警告する検証手順が追加され、問題が発生しなくなりました。(OCPBUGS-53261) - 以前は、共有 VPC にホステッドクラスターを作成すると、プライベートリンクコントローラーが共有 VPC 内の VPC エンドポイントを管理するための共有 VPC ロールを引き受けられない場合がありました。このリリースでは、プライベートリンクコントローラーでのすべてのリコンシリエーションに対してクライアントが作成されるため、無効なクライアントから回復できます。その結果、ホステッドクラスターエンドポイントとホステッドクラスターが正常に作成されます。(OCPBUGS-45184)

-

以前は、Agent プラットフォーム上の

NodePoolAPI で、ARM64 アーキテクチャーが許可されていませんでした。その結果、Agent プラットフォーム上に異種クラスターをデプロイできませんでした。このリリースでは、Agent プラットフォーム上で ARM64 ベースのNodePoolリソースが API によって許可されます。(OCPBUGS-46342) - 以前は、HyperShift Operator は常に Kubernetes API サーバーのサブジェクト代替名 (SAN) を検証していました。このリリースでは、PKI リコンシリエーションが有効になっている場合にのみ、Operator は SAN を検証します。(OCPBUGS-56562)

- 以前は、1 年超存在するホステッドクラスターでは、内部サービング証明書が更新されても、コントロールプレーンのワークロードは再起動されず、更新された証明書を取得できませんでした。その結果、コントロールプレーンが劣化した状態になりました。このリリースでは、証明書が更新されると、コントロールプレーンのワークロードが自動的に再起動されます。その結果、コントロールプレーンは安定した状態を維持します。(OCPBUGS-52331)

-

以前は、OpenShift OAuth API サーバーが管理するリソース (ユーザーやグループなど) に対して validating webhook を作成しても、その validating webhook は実行されませんでした。このリリースでは、

Konnectivityプロキシーサイドカーを追加することで、OpenShift OAuth API サーバーとデータプレーン間の通信が修正されました。その結果、ユーザーとグループに対する Webhook を検証するプロセスが期待どおりに機能します。(OCPBUGS-52190) -

以前は、

HostedClusterリソースが利用できない場合、その理由が条件内のHostedControlPlaneリソースから正しく伝播されませんでした。HostedClusterカスタムリソースのAvailable条件のStatusおよびMessage情報は伝播されましたが、Resourceの値は伝播されませんでした。このリリースでは、理由も伝播されるようになったため、利用不可の根本原因を特定するための情報がより多く得られます。(OCPBUGS-50907) -

以前は、

managed-trust-bundleボリュームマウントとtrusted-ca-bundle-managedconfig map が必須コンポーネントとして導入されていました。OpenShift API サーバーは、trusted-ca-bundle-managedconfig map の存在を想定していたため、独自の公開鍵基盤 (PKI) を使用した場合、この要件が原因でデプロイメントが失敗していました。この問題に対処するために、これらのコンポーネントはオプションになり、カスタム PKI を使用している場合はtrusted-ca-bundle-managedconfig map なしでクラスターを正常にデプロイできるようになりました。(OCPBUGS-52323) -

以前は、

IBMPowerVSImageリソースが削除されたことを確認する方法がなかったため、不要なクラスターの取得が試行されていました。その結果、IBM Power Virtual Server 上のホステッドクラスターは破棄状態のままになりました。このリリースでは、イメージが削除中でない場合にのみ、イメージに関連付けられているクラスターを取得して処理できます。(OCPBUGS-46037) -

以前は、セキュアプロキシーを有効にしてクラスターを作成し、証明書設定を

configuration.proxy.trustCAに設定すると、クラスターのインストールは失敗していました。さらに、OpenShift OAuth API サーバーは、管理クラスタープロキシーを使用してクラウド API にアクセスできませんでした。このリリースでは、これらの問題を防ぐための修正が導入されています。(OCPBUGS-51050) -

以前は、

NodePoolコントローラーとクラスター API コントローラーの両方が、NodePoolカスタムリソースにupdatingConfigステータス条件を設定していました。その結果、updatingConfigステータスは常に変更されていました。このリリースでは、updatingConfigステータスを更新するロジックが 2 つのコントローラー間で統合されました。その結果、updatingConfigステータスは正しく設定されるようになりました。(OCPBUGS-45322) - 以前は、コンテナーイメージアーキテクチャーを検証するプロセスは、イメージメタデータプロバイダーを経由しませんでした。その結果、イメージのオーバーライドは有効にならず、切断されたデプロイメントは失敗しました。このリリースでは、イメージメタデータプロバイダーのメソッドが、マルチアーキテクチャーの検証を可能にするように変更され、その変更はイメージ検証を行うすべてのコンポーネントに伝播されます。その結果、問題は解決しました。(OCPBUGS-44655)

-

以前は、Kubernetes API サーバーの

--goaway-chanceフラグは設定できませんでした。フラグのデフォルト値は0でした。このリリースでは、HostedClusterカスタムリソースにアノテーションを追加することで、--goaway-chanceフラグの値を変更できます。(OCPBUGS-54863) -

以前は、Hosted Control Plane に基づく Red Hat OpenShift on IBM Cloud のインスタンスの OVN 以外のクラスターでは、Cluster Network Operator は、

monitoring.coreos.comAPI グループのサービスモニターと Prometheus ルールにパッチを適用できませんでした。その結果、Cluster Network Operator ログに権限エラーと "could not apply" というメッセージが表示されました。このリリースでは、OVN 以外のクラスターの Cluster Network Operator にサービスモニターと Prometheus ルールの権限が追加されました。その結果、Cluster Network Operator ログに権限エラーが表示されなくなりました。(OCPBUGS-54178) - 以前は、Hosted Control Plane のコマンドラインインターフェイス (CLI) を使用して非接続クラスターを作成しようとすると、CLI がペイロードにアクセスできないため、作成に失敗していました。このリリースでは、リリースペイロードアーキテクチャーチェックは非接続環境ではスキップされます。これは、ホストされているレジストリーは通常、CLI が実行されているマシンからアクセスできないためです。その結果、CLI を使用して非接続クラスターを作成できるようになりました。(OCPBUGS-47715)

-

以前は、Control Plane Operator が API エンドポイントの可用性をチェックしたときに、Operator は設定された

_*PROXY変数を考慮しませんでした。その結果、プロキシー経由以外で Egress トラフィックがブロックされると、Kubernetes API サーバーを検証するための HTTP リクエストが失敗し、Hosted Control Plane とホステッドクラスターは利用できなくなりました。このリリースでは、この問題は解決されました。(OCPBUGS-49913) -

以前は、Hosted Control Plane CLI (

hcp) を使用してホステッドクラスターを作成すると、etcd ストレージサイズを設定できませんでした。その結果、一部の大規模なクラスターではディスクサイズが不十分になりました。このリリースでは、HostedClusterリソースにフラグを設定することで、etcd ストレージサイズを設定できます。このフラグは当初、OpenShift パフォーマンスチームが ROSA with HCP 上で、より大規模なNodePoolリソースのテストを支援するために追加されました。その結果、hcpCLI を使用してホステッドクラスターを作成するときに、etcd ストレージサイズを設定できるようになりました。(OCPBUGS-52655) - 以前は、インプレース更新を使用するホステッドクラスターを更新しようとすると、プロキシー変数が考慮されず、更新が失敗していました。このリリースでは、インプレースアップグレードを実行する Pod がクラスタープロキシー設定を考慮します。その結果、インプレース更新を使用するホステッドクラスターでも更新が機能するようになりました。(OCPBUGS-48540)

-

以前は、Hosted Control Plane の OpenShift API サーバーに関連付けられている liveness プローブと readiness プローブは、installer-provisioned infrastructure で使用されるプローブと一致していませんでした。このリリースでは、liveness プローブと readiness プローブが更新され、

/healthzエンドポイントの代わりに/livezエンドポイントと/readyzエンドポイントが使用されるようになりました。(OCPBUGS-54819) - 以前は、Hosted Control Plane 上の Konnectivity エージェントには readiness チェックがありませんでした。このリリースでは、Konnectivity サーバーへの接続が切断されたときに Pod の readiness を示す readiness プローブが Konnectivity エージェントに追加されました。(OCPBUGS-49611)

- 以前は、HyperShift Operator のスコープがホステッドクラスターとノードプールのサブセットに限定されていた場合、Operator はコントロールプレーンの namespace 内のトークンとユーザーデータシークレットを適切にクリーンアップしませんでした。その結果、シークレットは蓄積されました。このリリースでは、Operator はシークレットを適切にクリーンアップします。(OCPBUGS-54272)

1.1.3. 既知の問題

-

アノテーションと

ManagedClusterリソース名が一致しない場合、multicluster engine for Kubernetes Operator コンソールにはクラスターの状態がPending importとして表示されます。このようなクラスターは、multicluster engine Operator で使用できません。アノテーションがなく、ManagedCluster名がHostedClusterリソースのInfra-ID値と一致しない場合も、同じ問題が発生します。 - multicluster engine for Kubernetes Operator コンソールを使用して、既存のホステッドクラスターに新しいノードプールを追加すると、オプションのリストに同じバージョンの OpenShift Container Platform が複数回表示される場合があります。必要なバージョンの一覧で任意のインスタンスを選択できます。

ノードプールが 0 ワーカーにスケールダウンされても、コンソールのホストのリストには、

Ready状態のノードが表示されます。ノードの数は、次の 2 つの方法で確認できます。- コンソールでノードプールに移動し、ノードが 0 であることを確認します。

コマンドラインインターフェイスで、以下のコマンドを実行します。

次のコマンドを実行して、ノードプールにあるノード数が 0 個であることを確認します。

$ oc get nodepool -A次のコマンドを実行して、クラスター内にあるノード数が 0 個であることを確認します。

$ oc get nodes --kubeconfig次のコマンドを実行して、クラスターにバインドされているエージェント数が 0 と報告されていることを確認します。

$ oc get agents -A

-

デュアルスタックネットワークを使用する環境でホステッドクラスターを作成すると、

ContainerCreating状態のままになっている Pod が発生する可能性があります。この問題は、DNS Pod が DNS 解決に必要なmetrics-tlsシークレットをopenshift-service-ca-operatorリソースが生成できないために発生します。その結果、Pod は Kubernetes API サーバーを解決できません。この問題を解決するには、デュアルスタックネットワークの DNS サーバー設定を行います。 ホステッドクラスターをそのマネージドクラスターと同じ namespace に作成した場合、マネージドホステッドクラスターをデタッチすると、ホステッドクラスターが含まれるマネージドクラスター namespace 内のすべてが削除されます。次の状況では、マネージドクラスターと同じ namespace にホステッドクラスターが作成される可能性があります。

- デフォルトのホステッドクラスターのクラスター namespace を使用し、multicluster engine for Kubernetes Operator のコンソールを介して Agent プラットフォーム上にホステッドクラスターを作成した場合。

- ホステッドクラスターの namespace をホステッドクラスターの名前と同じになるよう指定して、コマンドラインインターフェイスまたは API を介してホステッドクラスターを作成した場合。

-

コンソールまたは API を使用して、ホステッドクラスターの

spec.services.servicePublishingStrategy.nodePort.addressフィールドに IPv6 アドレスを指定する場合、8 ヘクステットの完全な IPv6 アドレスが必要です。たとえば、2620:52:0:1306::30ではなく、2620:52:0:1306:0:0:0:30を指定する必要があります。 バージョン 4.19.3 以前では、ベアメタル Agent プラットフォーム上にホステッドクラスターを作成し、MetalLB Operator を使用すると、ホステッドクラスター内の Cluster Network Operator が起動に失敗します。以下のエラーが発生します。

"Error while updating operator configuration: could not apply (apps/v1, Kind=Deployment) openshift-frr-k8s/frr-k8s-webhook-server: failed to apply / update (apps/v1, Kind=Deployment) openshift-frr-k8s/frr-k8s-webhook-server: Deployment.apps \"frr-k8s-webhook-server\" is invalid: spec.template.spec.containers[0].image: Required value"この問題を回避するには、バージョン 4.19.4 以降にアップグレードしてください。

1.1.4. 一般提供とテクノロジープレビュー機能

現在、このリリースに含まれる機能にはテクノロジープレビューのものがあります。これらの実験的機能は、実稼働環境での使用を目的としていません。これらの機能のサポート範囲の詳細は、Red Hat カスタマーポータルの テクノロジープレビュー機能のサポート範囲 を参照してください。

IBM Power および IBM Z の場合、コントロールプレーンは 64 ビット x86 アーキテクチャーベースのマシンタイプで実行し、ノードプールは IBM Power または IBM Z で実行する必要があります。

| 機能 | 4.17 | 4.18 | 4.19 |

|---|---|---|---|

| 非ベアメタルエージェントマシンを使用した OpenShift Container Platform の Hosted Control Plane | テクノロジープレビュー | テクノロジープレビュー | テクノロジープレビュー |

| Amazon Web Services 上の ARM64 OpenShift Container Platform クラスター用の Hosted Control Plane | 一般提供 | 一般提供 | 一般提供 |

| IBM Power 上の OpenShift Container Platform の Hosted Control Plane | 一般提供 | 一般提供 | 一般提供 |

| IBM Z 上の OpenShift Container Platform の Hosted Control Plane | 一般提供 | 一般提供 | 一般提供 |

| RHOSP 上の OpenShift Container Platform の Hosted Control Plane | 開発者プレビュー | 開発者プレビュー | テクノロジープレビュー |

第2章 Hosted Control Plane の概要

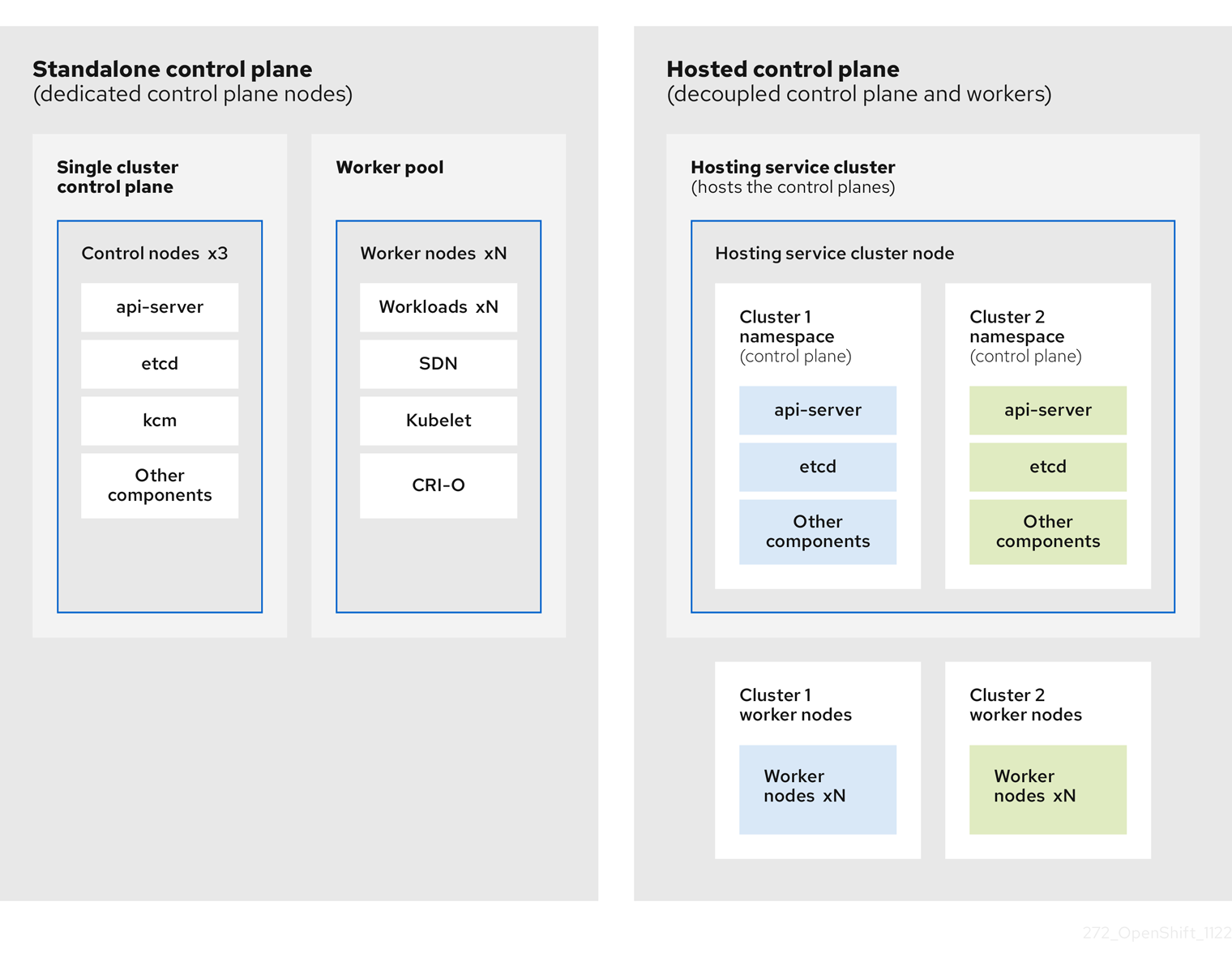

OpenShift Container Platform クラスターは、スタンドアロンまたは Hosted Control Plane という 2 つの異なるコントロールプレーン設定を使用してデプロイできます。スタンドアロン設定では、専用の仮想マシンまたは物理マシンを使用してコントロールプレーンをホストします。OpenShift Container Platform の Hosted Control Plane を使用すると、各コントロールプレーンに専用の仮想マシンまたは物理マシンを用意する必要なく、管理クラスター上の Pod としてコントロールプレーンを作成できます。

2.1. Hosted Control Plane の概要

Hosted Control Plane は、次のプラットフォームで サポートされているバージョンの multicluster engine for Kubernetes Operator を使用することで利用できます。

- Agent プロバイダーを使用したベアメタル

- 非ベアメタルエージェントマシン (テクノロジープレビュー機能)

- OpenShift Virtualization

- Amazon Web Services (AWS)

- IBM Z

- IBM Power

- Red Hat OpenStack Platform (RHOSP) 17.1 (テクノロジープレビュー機能)

Hosted Control Plane 機能はデフォルトで有効になっています。

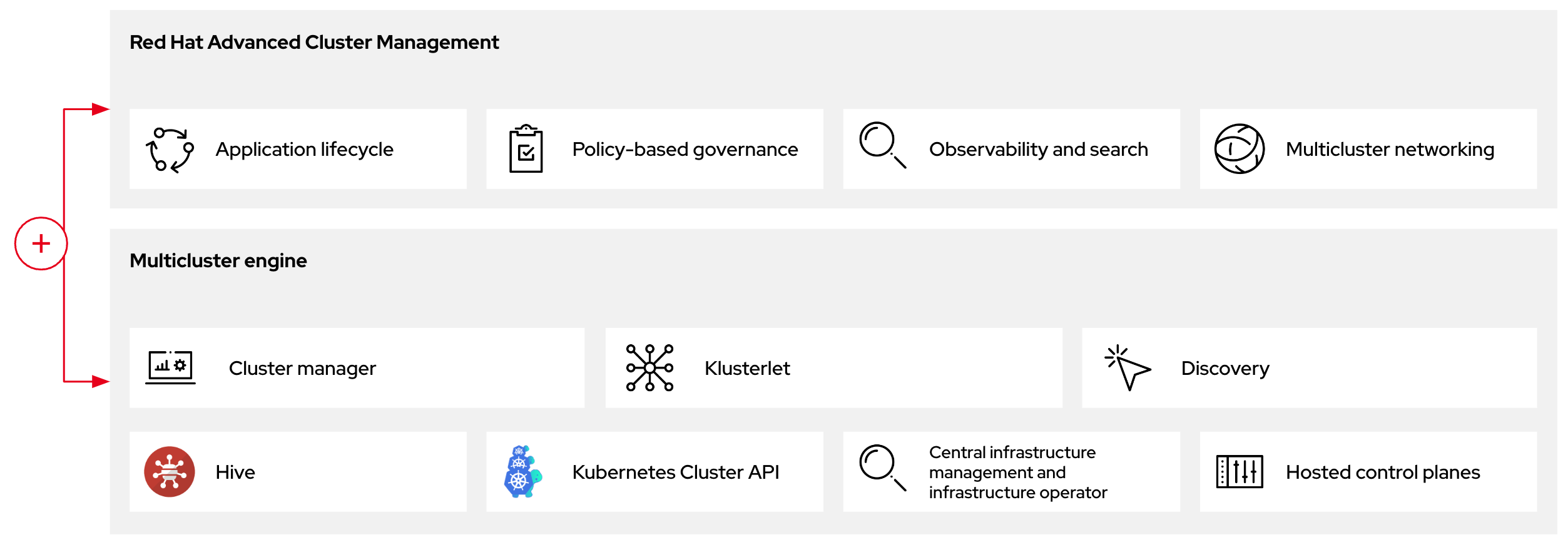

multicluster engine Operator は Red Hat Advanced Cluster Management (RHACM) の不可欠な要素であり、RHACM ではデフォルトで有効になっています。ただし、Hosted Control Plane を使用するのに RHACM は必要ありません。

2.1.1. Hosted Control Plane のアーキテクチャー

OpenShift Container Platform は、多くの場合、クラスターがコントロールプレーンとデータプレーンで構成される結合モデルまたはスタンドアロンモデルでデプロイされます。コントロールプレーンには、API エンドポイント、ストレージエンドポイント、ワークロードスケジューラー、および状態を保証するアクチュエーターが含まれます。データプレーンには、ワークロードとアプリケーションが実行されるコンピュート、ストレージ、およびネットワークが含まれます。

スタンドアロンコントロールプレーンは、クォーラムを確保できる最小限の数で、物理または仮想のノードの専用グループによってホストされます。ネットワークスタックは共有されます。クラスターへの管理者アクセスにより、クラスターのコントロールプレーン、マシン管理 API、およびクラスターの状態に影響を与える他のコンポーネントを可視化できます。

スタンドアロンモデルは正常に機能しますが、状況によっては、コントロールプレーンとデータプレーンが分離されたアーキテクチャーが必要になります。そのような場合には、データプレーンは、専用の物理ホスティング環境がある別のネットワークドメインに配置されています。コントロールプレーンは、Kubernetes にネイティブなデプロイやステートフルセットなど、高レベルのプリミティブを使用してホストされます。コントロールプレーンは、他のワークロードと同様に扱われます。

2.1.2. Hosted Control Plane の利点

Hosted Control Plane を使用すると、真のハイブリッドクラウドアプローチへの道が開かれ、その他のさまざまなメリットも享受できます。

- コントロールプレーンが分離され、専用のホスティングサービスクラスターでホストされるため、管理とワークロードの間のセキュリティー境界が強化されます。その結果、クラスターのクレデンシャルが他のユーザーに漏洩する可能性が低くなります。インフラストラクチャーのシークレットアカウント管理も分離されているため、クラスターインフラストラクチャーの管理者が誤ってコントロールプレーンインフラストラクチャーを削除することはありません。

- Hosted Control Plane を使用すると、より少ないノードで多数のコントロールプレーンを実行できます。その結果、クラスターはより安価になります。

- コントロールプレーンは OpenShift Container Platform で起動される Pod で構成されるため、コントロールプレーンはすぐに起動します。同じ原則が、モニタリング、ロギング、自動スケーリングなどのコントロールプレーンとワークロードに適用されます。

- インフラストラクチャーの観点からは、レジストリー、HAProxy、クラスター監視、ストレージノードなどのインフラストラクチャーをテナントのクラウドプロバイダーのアカウントにプッシュして、テナントでの使用を分離できます。

- 運用上の観点からは、マルチクラスター管理はさらに集約され、クラスターの状態と一貫性に影響を与える外部要因が少なくなります。Site Reliability Engineer は、一箇所で問題をデバッグしてクラスターのデータプレーンに移動できるため、解決までの時間 (TTR) が短縮され、生産性が向上します。

2.2. Hosted Control Plane と OpenShift Container Platform の違い

Hosted Control Plane は、OpenShift Container Platform の 1 つのフォームファクターです。ホステッドクラスターとスタンドアロンの OpenShift Container Platform クラスターは、設定と管理が異なります。OpenShift Container Platform と Hosted Control Plane の違いを理解するには、次の表を参照してください。

2.2.1. クラスターの作成とライフサイクル

| OpenShift Container Platform | Hosted Control Plane |

|---|---|

|

|

既存の OpenShift Container Platform クラスターに、 |

2.2.2. Cluster configuration

| OpenShift Container Platform | Hosted Control Plane |

|---|---|

|

|

コントロールプレーンに影響するリソースを、 |

2.2.3. etcd 暗号化

| OpenShift Container Platform | Hosted Control Plane |

|---|---|

|

|

|

2.2.4. Operator とコントロールプレーン

| OpenShift Container Platform | Hosted Control Plane |

|---|---|

| スタンドアロンの OpenShift Container Platform クラスターには、コントロールプレーンコンポーネントごとに個別の Operator が含まれています。 | ホステッドクラスターには、管理クラスターの Hosted Control Plane の namespace で実行される Control Plane Operator という名前の単一の Operator が含まれています。 |

| etcd は、コントロールプレーンノードにマウントされたストレージを使用します。etcd のクラスター Operator が etcd を管理します。 | etcd は、ストレージに永続ボリューム要求を使用し、Control Plane Operator によって管理されます。 |

| Ingress Operator、ネットワーク関連の Operator、および Operator Lifecycle Manager (OLM) は、クラスター上で実行されます。 | Ingress Operator、ネットワーク関連の Operator、および Operator Lifecycle Manager (OLM) は、管理クラスターの Hosted Control Plane の namespace で実行されます。 |

| OAuth サーバーは、クラスター内で実行され、クラスター内のルートを通じて公開されます。 | OAuth サーバーは、コントロールプレーン内で実行され、管理クラスター上のルート、ノードポート、またはロードバランサーを通じて公開されます。 |

2.2.5. 更新

| OpenShift Container Platform | Hosted Control Plane |

|---|---|

|

Cluster Version Operator (CVO) が更新プロセスをオーケストレーションし、 |

Hosted Control Plane を更新すると、 |

| OpenShift Container Platform クラスターを更新すると、コントロールプレーンとコンピュートマシンの両方が更新されます。 | ホステッドクラスターを更新すると、コントロールプレーンのみが更新されます。ノードプールの更新は個別に実行します。 |

2.2.6. マシンの設定と管理

| OpenShift Container Platform | Hosted Control Plane |

|---|---|

|

|

|

| コントロールプレーンマシンのセットが利用可能です。 | コントロールプレーンマシンのセットが存在しません。 |

|

|

|

|

|

|

| マシンとマシンセットがクラスター内で公開されます。 | アップストリームの Cluster CAPI Operator からのマシン、マシンセット、およびマシンデプロイメントが、マシンを管理するために使用されます。ただし、これらはユーザーには公開されません。 |

| クラスターを更新すると、すべてのマシンセットが自動的にアップグレードされます。 | ホステッドクラスターの更新とは別にノードプールを更新します。 |

| インプレースアップグレードだけがクラスターでサポートされています。 | 置換アップグレードとインプレースアップグレードの両方が、ホステッドクラスターでサポートされています。 |

| Machine Config Operator がマシンの設定を管理します。 | Hosted Control Plane には Machine Config Operator が存在しません。 |

|

|

|

| Machine Config Daemon (MCD) が各ノードの設定の変更と更新を管理します。 | インプレースアップグレードの場合、ノードプールコントローラーが、一度だけ実行され、設定に基づいてマシンを更新する Pod を作成します。 |

| SR-IOV Operator などのマシン設定リソースを変更できます。 | マシン設定リソースを変更することはできません。 |

2.2.7. ネットワーク

| OpenShift Container Platform | Hosted Control Plane |

|---|---|

| Kube API サーバーとノードが同じ Virtual Private Cloud (VPC) 内に存在するため、Kube API サーバーはノードと直接通信します。 | Kube API サーバーは Konnectivity を介してノードと通信します。Kube API サーバーとノードは、別々の Virtual Private Cloud (VPC) 内に存在します。 |

| ノードは内部ロードバランサーを介して Kube API サーバーと通信します。 | ノードは外部ロードバランサーまたはノードポートを介して Kube API サーバーと通信します。 |

2.2.8. Web コンソール

| OpenShift Container Platform | Hosted Control Plane |

|---|---|

| Web コンソールにコントロールプレーンのステータスが表示されます。 | Web コンソールにコントロールプレーンのステータスが表示されません。 |

| Web コンソールを使用してクラスターを更新できます。 | Web コンソールを使用してホステッドクラスターを更新することはできません。 |

| Web コンソールにマシンなどのインフラストラクチャーリソースが表示されます。 | Web コンソールにインフラストラクチャーリソースが表示されません。 |

|

Web コンソールを使用して、 | Web コンソールを使用してマシンを設定することはできません。 |

2.3. Hosted Control Plane、multicluster engine Operator、および RHACM の関係

Hosted Control Plane は、multicluster engine for Kubernetes Operator を使用して設定できます。multicluster engine Operator のクラスターライフサイクルにより、さまざまなインフラストラクチャークラウドプロバイダー、プライベートクラウド、オンプレミスデータセンターにおける Kubernetes クラスターの作成、インポート、管理、破棄のプロセスが定義されます。

multicluster engine Operator は Red Hat Advanced Cluster Management (RHACM) の不可欠な要素であり、RHACM ではデフォルトで有効になっています。ただし、Hosted Control Plane を使用するのに RHACM は必要ありません。

multicluster engine Operator は、OpenShift Container Platform および RHACM ハブクラスターにクラスター管理機能を提供するクラスターライフサイクル Operator です。multicluster engine Operator は、クラスター群の管理を強化し、クラウドとデータセンター全体の OpenShift Container Platform クラスターのライフサイクル管理を支援します。

図2.1 クラスターライフサイクルと基盤

OpenShift Container Platform の multicluster engine Operator は、スタンドアロンクラスターマネージャーとして、または RHACM ハブクラスターの一部として使用できます。

管理クラスターはホスティングクラスターとも呼ばれます。

OpenShift Container Platform クラスターは、スタンドアロンまたは Hosted Control Plane という 2 つの異なるコントロールプレーン設定を使用してデプロイできます。スタンドアロン設定では、専用の仮想マシンまたは物理マシンを使用してコントロールプレーンをホストします。OpenShift Container Platform の Hosted Control Plane を使用すると、各コントロールプレーンに専用の仮想マシンまたは物理マシンを用意する必要なく、管理クラスター上の Pod としてコントロールプレーンを作成できます。

図2.2 RHACM と multicluster engine Operator の概要図

2.3.1. RHACM での multicluster engine Operator ホステッドクラスターの検出

ホステッドクラスターを Red Hat Advanced Cluster Management (RHACM) ハブクラスターに移行し、RHACM 管理コンポーネントを使用して管理する場合は、Red Hat Advanced Cluster Management の公式ドキュメント の手順を参照してください。

2.4. Hosted Control Plane のバージョン管理

Hosted Control Plane 機能には次のコンポーネントが含まれています。これらのコンポーネントには、個別のバージョン管理とサポートレベルが必要な場合があります。

- 管理クラスター

- HyperShift Operator

-

Hosted Control Plane (

hcp) コマンドラインインターフェイス (CLI) -

hypershift.openshift.ioAPI - Control Plane Operator

2.4.1. 管理クラスター

実稼働環境で使用する管理クラスターでは、OperatorHub から入手できる multicluster engine for Kubernetes Operator が必要です。multicluster engine Operator には、HyperShift Operator のサポートされているビルドがバンドルされています。管理クラスターのサポートを継続するには、multicluster engine Operator が動作する OpenShift Container Platform のバージョンを使用する必要があります。一般に、multicluster engine Operator の新しいリリースは、以下の OpenShift Container Platform のバージョンで動作します。

- OpenShift Container Platform の最新の一般提供バージョン

- OpenShift Container Platform の最新の一般提供バージョンより 2 つ前のバージョン

管理クラスター上の HyperShift Operator を通じてインストールできる OpenShift Container Platform バージョンの完全なリストは、HyperShift Operator のバージョンによって異なります。ただし、リストには常に、管理クラスターと同じ OpenShift Container Platform バージョンと、管理クラスターよりも 2 つ前のマイナーバージョンが含まれます。たとえば、管理クラスターが 4.17 とサポートされているバージョンの multicluster engine Operator を実行している場合、HyperShift Operator は 4.17、4.16、4.15、および 4.14 ホステッドクラスターをインストールできます。

OpenShift Container Platform のメジャー、マイナー、またはパッチバージョンのリリースごとに、Hosted Control Plane の 2 つのコンポーネントがリリースされます。

- HyperShift Operator

-

hcpコマンドラインインターフェイス (CLI)

2.4.2. HyperShift Operator

HyperShift Operator は、HostedCluster API リソースによって表されるホステッドクラスターのライフサイクルを管理します。HyperShift Operator は、OpenShift Container Platform の各リリースでリリースされます。HyperShift Operator は、hypershift namespace に supported-versions config map を作成します。この config map には、サポートされているホステッドクラスターのバージョンが含まれています。

同じ管理クラスター上で異なるバージョンのコントロールプレーンをホストできます。

supported-versions config map オブジェクトの例

apiVersion: v1

data:

supported-versions: '{"versions":["4.19"]}'

kind: ConfigMap

metadata:

labels:

hypershift.openshift.io/supported-versions: "true"

name: supported-versions

namespace: hypershift2.4.3. Hosted Control Plane CLI

hcp CLI を使用してホステッドクラスターを作成できます。CLI は multicluster engine Operator からダウンロードできます。hcp version コマンドを実行すると、CLI が kubeconfig ファイルに対してサポートする最新の OpenShift Container Platform が出力に表示されます。

2.4.4. hypershift.openshift.io API

HostedCluster や NodePool などの hypershift.openshift.io API リソースを使用して、大規模な OpenShift Container Platform クラスターを作成および管理できます。HostedCluster リソースには、コントロールプレーンと共通データプレーンの設定が含まれます。HostedCluster リソースを作成すると、ノードが接続されていない、完全に機能するコントロールプレーンが作成されます。NodePool リソースは、HostedCluster リソースにアタッチされたスケーラブルなワーカーノードのセットです。

API バージョンポリシーは、通常、Kubernetes API のバージョン管理 のポリシーと一致します。

Hosted Control Plane の更新には、ホステッドクラスターとノードプールの更新が含まれます。詳細は、「Hosted Control Plane の更新」を参照してください。

2.4.5. Control Plane Operator

Control Plane Operator は、次のアーキテクチャー用の各 OpenShift Container Platform ペイロードリリースイメージの一部としてリリースされます。

- amd64

- arm64

- multi-arch

2.5. Hosted Control Plane の一般的な概念とペルソナの用語集

OpenShift Container Platform の Hosted Control Plane を使用する場合は、その主要な概念と関連するペルソナを理解することが重要です。

2.5.1. 概念

- データプレーン

- ワークロードとアプリケーションが実行されるコンピュート、ストレージ、ネットワークを含む、クラスターの一部分。

- ホステッドクラスター

- コントロールプレーンと API エンドポイントが管理クラスターでホストされている OpenShift Container Platform クラスター。ホステッドクラスターには、コントロールプレーンとそれに対応するデータプレーンが含まれます。

- ホステッドクラスターのインフラストラクチャー

- テナントまたはエンドユーザーのクラウドアカウントに存在するネットワーク、コンピュート、およびストレージリソース。

- Hosted Control Plane

- 管理クラスターで実行される OpenShift Container Platform コントロールプレーン。ホステッドクラスターの API エンドポイントによって公開されます。コントロールプレーンのコンポーネントには、etcd、Kubernetes API サーバー、Kubernetes コントローラーマネージャー、および VPN が含まれます。

- ホスティングクラスター

- 管理クラスター を参照してください。

- マネージドクラスター

- ハブクラスターが管理するクラスター。この用語は、Red Hat Advanced Cluster Management で multicluster engine for Kubernetes Operator が管理するクラスターライフサイクル特有の用語です。マネージドクラスターは、管理クラスター とは異なります。詳細は、マネージドクラスター を参照してください。

- 管理クラスター

- HyperShift Operator がデプロイされる OpenShift Container Platform クラスター。ホステッドクラスターのコントロールプレーンをホストします。管理クラスターは ホスティングクラスター と同義です。

- 管理クラスターのインフラストラクチャー

- 管理クラスターのネットワーク、コンピュート、およびストレージリソース。

- ノードプール

- ホステッドクラスターに関連付けられたコンピュートノードのセットを管理するリソース。コンピュートノードは、ホステッドクラスター内でアプリケーションとワークロードを実行します。

2.5.2. ペルソナ

- クラスターインスタンス管理者

-

このロールを引き受けるユーザーは、スタンドアロン OpenShift Container Platform の管理者と同等です。このユーザーには、プロビジョニングされたクラスター内で

cluster-adminロールがありますが、クラスターがいつ、どのように更新または設定されるかを制御できない可能性があります。このユーザーは、クラスターに投影された設定を表示するための読み取り専用アクセス権を持っている可能性があります。 - クラスターインスタンスユーザー

- このロールを引き受けるユーザーは、スタンドアロン OpenShift Container Platform の開発者と同等です。このユーザーには、OperatorHub またはマシンに対するビューがありません。

- クラスターサービスコンシューマー

- このロールを引き受けるユーザーは、コントロールプレーンとワーカーノードを要求したり、更新を実行したり、外部化された設定を変更したりできます。通常、このユーザーはクラウド認証情報やインフラストラクチャー暗号化キーを管理したりアクセスしたりしません。クラスターサービスのコンシューマーペルソナは、ホステッドクラスターを要求し、ノードプールと対話できます。このロールを引き受けるユーザーには、論理境界内でホステッドクラスターとノードプールを作成、読み取り、更新、または削除するための RBAC があります。

- クラスターサービスプロバイダー

このロールを引き受けるユーザーは通常、管理クラスター上で

cluster-adminロールを持ち、HyperShift Operator とテナントのホステッドクラスターのコントロールプレーンの可用性を監視および所有するための RBAC を持っています。クラスターサービスプロバイダーのペルソナは、次の例を含むいくつかのアクティビティーを担当します。- コントロールプレーンの可用性、稼働時間、安定性を確保するためのサービスレベルオブジェクトの所有

- コントロールプレーンをホストするための管理クラスターのクラウドアカウントの設定

- ユーザーがプロビジョニングするインフラストラクチャーの設定 (利用可能なコンピュートリソースのホスト認識を含む)

第3章 Hosted Control Plane のデプロイの準備

3.1. Hosted Control Plane の要件

Hosted Control Plane において、管理クラスター とは HyperShift Operator がデプロイされ、ホステッドクラスターのコントロールプレーンがホストされる OpenShift Container Platform クラスターです。

コントロールプレーンはホステッドクラスターに関連付けられており、単一の namespace 内の Pod として実行されます。クラスターのサービスコンシューマーがホステッドクラスターを作成すると、コントロールプレーンから独立したワーカーノードが作成されます。

Hosted Control Plane には次の要件が適用されます。

- HyperShift Operator を実行するには、管理クラスターに少なくとも 3 つのワーカーノードが必要です。

-

ドメインネームサービス (DNS) プロトコルが期待どおりに動作できるように、Transmission Control Protocol (TCP) および User Datagram Protocol (UDP) のファイアウォールポート

53を開く必要があります。 - 管理クラスターとワーカーノードの両方を、オンプレミス (ベアメタルプラットフォームや OpenShift Virtualization 上など) で実行できます。さらに、管理クラスターとワーカーノードの両方を、Amazon Web Services (AWS) などのクラウドインフラストラクチャー上で実行することもできます。

-

管理クラスターを AWS で実行し、ワーカーノードをオンプレミスで実行する、またはワーカーノードを AWS で実行し、管理クラスターをオンプレミスで実行するなど、混合インフラストラクチャーを使用する場合は、

PublicAndPrivate公開ストラテジーを使用し、サポートマトリックスのレイテンシー要件に従う必要があります。 - Bare Metal Operator がマシンを起動するベアメタルホスト (BMH) デプロイメントでは、Hosted Control Plane が Baseboard Management Controller (BMC) にアクセスできる必要があります。Redfish の自動化を有効にするために、BMH の BMC があるネットワークに Cluster Baremetal Operator がアクセスすることをセキュリティープロファイルで禁止している場合は、BYO ISO サポートを使用できます。ただし、BYO モードでは、OpenShift Container Platform は BMH の電源オンを自動化できません。

3.1.1. Hosted Control Plane のサポートマトリックス

Multicluster engine for Kubernetes Operator には HyperShift Operator が含まれているため、Hosted Control Plane のリリースは multicluster engine Operator のリリースと一致します。詳細は、OpenShift Operator のライフサイクル を参照してください。

3.1.1.1. 管理クラスターのサポート

サポートされているスタンドアロンの OpenShift Container Platform クラスターは、すべて管理クラスターにすることができます。

シングルノードの OpenShift Container Platform クラスターは、管理クラスターとしてはサポートされていません。リソースに制約がある場合は、スタンドアロンの OpenShift Container Platform コントロールプレーンと Hosted Control Plane 間でインフラストラクチャーを共有できます。詳細は、「Hosted Control Plane とスタンドアロンコントロールプレーン間でのインフラストラクチャーの共有」を参照してください。

次の表は、multicluster engine Operator のバージョンと、それらをサポートする管理クラスターのバージョンをマッピングしています。

| 管理クラスターのバージョン | サポートされている multicluster engine Operator バージョン |

|---|---|

| 4.14 - 4.15 | 2.4 |

| 4.14 - 4.16 | 2.5 |

| 4.14 - 4.17 | 2.6 |

| 4.15 - 4.17 | 2.7 |

| 4.16 - 4.18 | 2.8 |

| 4.17 - 4.19 | 2.9 |

3.1.1.2. ホステッドクラスターのサポート

ホステッドクラスターの場合、管理クラスターのバージョンとホステッドクラスターのバージョンの間に直接的な関係はありません。ホステッドクラスターのバージョンは、使用している multicluster engine Operator バージョンに含まる HyperShift Operator により異なります。

管理クラスターとホステッドクラスター間の最大遅延が 200 ミリ秒であることを確認してください。この要件は、管理クラスターが AWS 上にあり、コンピュートノードがオンプレミスにある場合など、混合インフラストラクチャーのデプロイメントでは特に重要です。

次の表は、multicluster engine Operator のバージョンに関連付けられた HyperShift Operator を使用して作成できるホステッドクラスターバージョンを示しています。

HyperShift Operator は次の表に示すホステッドクラスターのバージョンをサポートしていますが、multicluster engine Operator は現行バージョンから 2 バージョン前までしかサポートしていません。たとえば、現在のホステッドクラスターのバージョンが 4.19 の場合、multicluster engine Operator はバージョン 4.17 までサポートします。multicluster engine Operator がサポートするバージョンよりも前のホステッドクラスターバージョンを使用する場合は、multicluster engine Operator からホステッドクラスターをデタッチして管理対象外にするか、multicluster engine Operator の以前のバージョンを使用できます。ホステッドクラスターを multicluster engine Operator から切り離す手順については、管理からのクラスターの削除 (RHACM ドキュメント) を参照してください。multicluster engine Operator のサポートに関する詳細は、The multicluster engine for Kubernetes operator 2.9 Support Matrix (Red Hat ナレッジベース) を参照してください。

| ホステッドクラスターのバージョン | HyperShift Operator in multicluster engine Operator 2.4 | HyperShift Operator in multicluster engine Operator 2.5 | HyperShift Operator in multicluster engine Operator 2.6 | HyperShift Operator in multicluster engine Operator 2.7 | HyperShift Operator in multicluster engine Operator 2.8 | HyperShift Operator in multicluster engine Operator 2.9 |

|---|---|---|---|---|---|---|

| 4.14 | はい | はい | はい | はい | はい | はい |

| 4.15 | いいえ | はい | はい | はい | はい | はい |

| 4.16 | いいえ | いいえ | はい | はい | はい | はい |

| 4.17 | いいえ | いいえ | いいえ | はい | はい | はい |

| 4.18 | いいえ | いいえ | いいえ | いいえ | はい | はい |

| 4.19 | いいえ | いいえ | いいえ | いいえ | いいえ | はい |

3.1.1.3. ホステッドクラスタープラットフォームのサポート

ホステッドクラスターは、1 つのインフラストラクチャープラットフォームのみサポートします。たとえば、異なるインフラストラクチャープラットフォーム上に複数のノードプールを作成することはできません。

次の表は、Hosted Control Plane の各プラットフォームでサポートされている OpenShift Container Platform のバージョンを示しています。

IBM Power および IBM Z の場合、コントロールプレーンは 64 ビット x86 アーキテクチャーベースのマシンタイプで実行し、ノードプールは IBM Power または IBM Z で実行する必要があります。

次の表に示す管理クラスターのバージョンは、multicluster engine Operator が有効になっている OpenShift Container Platform バージョンです。

| ホステッドクラスターのプラットフォーム | 管理クラスターのバージョン | ホステッドクラスターのバージョン |

|---|---|---|

| Amazon Web Services | 4.16 - 4.19 | 4.16 - 4.19 |

| IBM Power | 4.17 - 4.19 | 4.17 - 4.19 |

| IBM Z | 4.17 - 4.19 | 4.17 - 4.19 |

| OpenShift Virtualization | 4.14 - 4.19 | 4.14 - 4.19 |

| ベアメタル | 4.14 - 4.19 | 4.14 - 4.19 |

| 非ベアメタルエージェントマシン (テクノロジープレビュー) | 4.16 - 4.19 | 4.16 - 4.19 |

| Red Hat OpenStack Platform (RHOSP) (テクノロジープレビュー) | 4.19 | 4.19 |

3.1.1.4. マルチアーキテクチャーのサポート

次の表は、プラットフォーム別に、マルチアーキテクチャー上の Hosted Control Plane のサポート状況を示しています。

| OpenShift Container Platform バージョン | ARM64 コントロールプレーン | ARM64 コンピュートノード |

|---|---|---|

| 4.19 | 一般提供 | 一般提供 |

| 4.18 | 一般提供 | 一般提供 |

| 4.17 | 一般提供 | 一般提供 |

| 4.16 | テクノロジープレビュー | 一般提供 |

| 4.15 | テクノロジープレビュー | 一般提供 |

| 4.14 | テクノロジープレビュー | 一般提供 |

| OpenShift Container Platform バージョン | ARM64 コントロールプレーン | ARM64 コンピュートノード |

|---|---|---|

| 4.19 | 利用不可 | テクノロジープレビュー |

| 4.18 | 利用不可 | テクノロジープレビュー |

| 4.17 | 利用不可 | テクノロジープレビュー |

| 4.16 | 利用不可 | テクノロジープレビュー |

| 4.15 | 利用不可 | テクノロジープレビュー |

| 4.14 | 利用不可 | テクノロジープレビュー |

| OpenShift Container Platform バージョン | ARM64 コントロールプレーン | ARM64 コンピュートノード |

|---|---|---|

| 4.19 | 利用不可 | 利用不可 |

| 4.18 | 利用不可 | 利用不可 |

| 4.17 | 利用不可 | 利用不可 |

| OpenShift Container Platform バージョン | コントロールプレーン | Compute nodes |

|---|---|---|

| 4.19 |

|

|

| 4.18 |

|

|

| 4.17 |

|

|

| OpenShift Container Platform バージョン | コントロールプレーン | Compute nodes |

|---|---|---|

| 4.19 |

|

|

| 4.18 |

|

|

| 4.17 |

|

|

| OpenShift Container Platform バージョン | ARM64 コントロールプレーン | ARM64 コンピュートノード |

|---|---|---|

| 4.19 | 利用不可 | 利用不可 |

| 4.18 | 利用不可 | 利用不可 |

| 4.17 | 利用不可 | 利用不可 |

| 4.16 | 利用不可 | 利用不可 |

| 4.15 | 利用不可 | 利用不可 |

| 4.14 | 利用不可 | 利用不可 |

3.1.1.5. multicluster engine Operator の更新

multicluster engine Operator の別バージョンに更新する場合、その multicluster engine Operator バージョンに含まれる HyperShift Operator がサポートしているバージョンのホステッドクラスターは、引き続き実行できます。次の表は、更新後の multicluster engine Operator バージョンでサポートされるホステッドクラスターバージョンを示しています。

HyperShift Operator は次の表に示すホステッドクラスターのバージョンをサポートしていますが、multicluster engine Operator は現行バージョンから 2 バージョン前までしかサポートしていません。たとえば、現在のホステッドクラスターのバージョンが 4.19 の場合、multicluster engine Operator はバージョン 4.17 までサポートします。multicluster engine Operator がサポートするバージョンよりも前のホステッドクラスターバージョンを使用する場合は、multicluster engine Operator からホステッドクラスターをデタッチして管理対象外にするか、multicluster engine Operator の以前のバージョンを使用できます。ホステッドクラスターを multicluster engine Operator から切り離す手順については、管理からのクラスターの削除 (RHACM ドキュメント) を参照してください。multicluster engine Operator のサポートに関する詳細は、The multicluster engine for Kubernetes operator 2.9 Support Matrix (Red Hat ナレッジベース) を参照してください。

| 更新後の multicluster engine Operator バージョン | サポートされるホステッドクラスターバージョン |

|---|---|

| 2.4 から 2.5 に更新 | OpenShift Container Platform 4.14 |

| 2.5 から 2.6 に更新 | OpenShift Container Platform 4.14 - 4.15 |

| 2.6 から 2.7 に更新 | OpenShift Container Platform 4.14 - 4.16 |

| 2.7 から 2.8 に更新 | OpenShift Container Platform 4.14 - 4.17 |

| 2.8 から 2.9 に更新 | OpenShift Container Platform 4.14 - 4.18 |

たとえば、管理クラスターに OpenShift Container Platform 4.14 ホステッドクラスターがあり、multicluster engine Operator 2.4 から 2.5 に更新した場合、ホステッドクラスターは引き続き実行できます。

3.1.1.6. テクノロジープレビュー機能

次のリストは、このリリースでテクノロジープレビューステータスになっている機能を示しています。

- 非接続環境の IBM Z の Hosted Control Plane

- Hosted Control Plane のカスタムの taint と toleration

- OpenShift Virtualization の Hosted Control Plane 上の NVIDIA GPU デバイス

- Red Hat OpenStack Platform (RHOSP) 上の Hosted Control Plane

3.1.2. FIPS 対応ホステッドクラスター

Hosted Control Plane のバイナリーは、Hosted Control Plane コマンドラインインターフェイス hcp を除き、FIP に準拠しています。

FIPS 対応のホステッドクラスターをデプロイする場合は、FIPS 対応の管理クラスターを使用する必要があります。管理クラスターで FIPS モードを有効にするには、FIPS モードで動作するように設定された Red Hat Enterprise Linux (RHEL) コンピューターからインストールプログラムを実行する必要があります。RHEL で FIPS モードを設定する方法の詳細は、RHEL から FIPS モードへの切り替え を参照してください。

FIPS モードでブートされた RHEL または Red Hat Enterprise Linux CoreOS (RHCOS) を実行する場合、OpenShift Container Platform コアコンポーネントは、x86_64、ppc64le、および s390x アーキテクチャーでのみ、FIPS 140-2/140-3 検証のために NIST に提出された RHEL 暗号化ライブラリーを使用します。

管理クラスターを FIPS モードでセットアップすると、その管理クラスター上でホステッドクラスターの作成プロセスが実行されます。

3.1.3. Hosted Control Plane の CIDR 範囲

OpenShift Container Platform に Hosted Control Plane をデプロイするには、次の必須の Classless Inter-Domain Routing (CIDR) サブネット範囲を使用してください。

-

v4InternalSubnet: 100.65.0.0/16 (OVN-Kubernetes) -

clusterNetwork: 10.132.0.0/14 (Pod ネットワーク) -

serviceNetwork: 172.31.0.0/16

OpenShift Container Platform の CIDR 範囲の定義に関する詳細は、「CIDR 範囲の定義」を参照してください。

3.2. Hosted Control Plane のサイジングに関するガイダンス

一定数のワーカーノード内に収容できる Hosted Control Plane の数には、ホステッドクラスターのワークロードやワーカーノードの数など、多くの要因が影響します。このサイジングガイドを使用して、ホステッドクラスターの容量計画に役立ててください。このガイダンスでは、高可用性 Hosted Control Plane トポロジーを前提としています。負荷ベースのサイジングの例は、ベアメタルクラスターで測定されました。クラウドベースのインスタンスには、メモリーサイズなど、さまざまな制限要因が含まれる場合があります。

次のリソース使用量のサイズ測定値をオーバーライドし、メトリクスサービスの監視を無効化することもできます。

次の高可用性 Hosted Control Plane の要件を参照してください。この要件は、OpenShift Container Platform バージョン 4.12.9 以降でテストされたものです。

- 78 Pod

- etcd 用の 3 つの 8 GiB PV

- 最小仮想 CPU: 約 5.5 コア

- 最小メモリー: 約 19 GiB

3.2.1. Pod の制限

各ノードの maxPods 設定は、コントロールプレーンノードに収容できるホステッドクラスターの数に影響します。すべてのコントロールプレーンノードの maxPods 値に注意することが重要です。高可用性の Hosted Control Plane ごとに約 75 個の Pod を計画します。

ベアメタルノードの場合、マシンに十分なリソースがある場合でも、Pod 要件を考慮すると、各ノードに約 3 つの Hosted Control Plane が使用されるため、デフォルトで maxPods 設定に 250 が指定されていることが制限要因となる可能性があります。KubeletConfig 値を設定して maxPods 値を 500 に設定すると、Hosted Control Plane の密度が増し、追加のコンピュートリソースを活用できるようになります。

3.2.2. 要求ベースのリソース制限

クラスターがホストできる Hosted Control Plane の最大数は、Pod からの Hosted Control Plane CPU およびメモリー要求に基づいて計算されます。

高可用性 Hosted Control Plane は、5 つの仮想 CPU と 18 GB のメモリーを要求する 78 個の Pod で構成されます。これらのベースライン数値は、クラスターワーカーノードのリソース容量と比較され、Hosted Control Plane の最大数を推定します。

3.2.3. 負荷ベースの制限

クラスターがホストできる Hosted Control Plane の最大数は、Hosted Control Plane の Kubernetes API サーバーに何らかのワークロードが配置されたときの Hosted Control Plane Pod の CPU とメモリーの使用量に基づいて計算されます。

次の方法を使用して、ワークロードの増加に伴う Hosted Control Plane のリソース使用量を測定しました。

- KubeVirt プラットフォームを使用し、それぞれ 8 つの仮想 CPU と 32 GiB を使用する 9 つのワーカーを持つホステッドクラスター

次の定義に基づいて、API コントロールプレーンのストレスに重点を置くように設定されたワークロードテストプロファイル:

- 各 namespace にオブジェクトを作成し、合計 100 の namespace まで拡張しました。

- オブジェクトの継続的な削除と作成により、API のストレスを増加させます。

- ワークロードの 1 秒あたりのクエリー数 (QPS) とバースト設定を高く設定して、クライアント側のスロットリングを排除します。

負荷が 1000 QPS 増加すると、Hosted Control Plane のリソース使用量が、仮想 CPU 9 個分およびメモリー 2.5 GB 分増加します。

一般的なサイジングが目的の場合は、1000 QPS の API レートを 中程度 のホステッドクラスターの負荷、2000 QPS の API レートを 高程度 のホステッドクラスターの負荷とみなしてください。

このテストでは、予想される API 負荷に基づいてコンピュートリソースの使用量を増やすために、推定係数を定めています。正確な使用率は、クラスターのワークロードのタイプとペースによって異なる場合があります。

次の例は、ワークロードおよび API レート定義の Hosted Control Plane リソースのスケーリングを示しています。

| QPS (API レート) | 仮想 CPU の使用量 | メモリーの使用量 (GiB) |

|---|---|---|

| 低負荷 (50 QPS 未満) | 2.9 | 11.1 |

| 中負荷 (1000 QPS) | 11.9 | 13.6 |

| 高負荷 (2000 QPS) | 20.9 | 16.1 |

Hosted Control Plane のサイジングは、コントロールプレーンの負荷と、大量の API アクティビティー、etcd アクティビティー、またはその両方を引き起こすワークロードに関係します。データベースの実行など、データプレーンの負荷に重点を置くホスト型 Pod ワークロードでは、API レートが高くならない可能性があります。

3.2.4. サイジング計算の例

この例では、次のシナリオに対してサイジングのガイダンスを提供します。

-

hypershift.openshift.io/control-planeノードとしてラベル付けされたベアメタルワーカー 3 つ -

maxPods値を 500 に設定している - 負荷ベースの制限に応じて、予想される API レートは中または約 1000 である

| 制限の説明 | サーバー 1 | サーバー 2 |

|---|---|---|

| ワーカーノード上の仮想 CPU 数 | 64 | 128 |

| ワーカーノードのメモリー (GiB) | 128 | 256 |

| ワーカーあたりの最大 Pod 数 | 500 | 500 |

| コントロールプレーンのホストに使用されるワーカーの数 | 3 | 3 |

| 最大 QPS ターゲットレート (1 秒あたりの API リクエスト) | 1000 | 1000 |

| ワーカーノードのサイズと API レートに基づいた計算値 | サーバー 1 | サーバー 2 | 計算の注記 |

| 仮想 CPU リクエストに基づくワーカーあたりの最大ホストコントロールプレーン数 | 12.8 | 25.6 | ワーカーの仮想 CPU の数 ÷ Hosted Control Plane あたりの合計仮想 CPU 要求数 5 |

| 仮想 CPU 使用率に基づくワーカーあたりの最大 Hosted Control Plane 数 | 5.4 | 10.7 | 仮想 CPU の数 ÷ (アイドル状態の仮想 CPU 使用率の測定値 2.9 + (QPS ターゲットレート ÷ 1000) x QPS 増分 1000 あたりの仮想 CPU 使用率の測定値 9.0) |

| メモリーリクエストに基づくワーカーごとの最大 Hosted Control Plane | 7.1 | 14.2 | ワーカーのメモリー (GiB) ÷ Hosted Control Plane あたりの合計メモリー要求 18 GiB |

| メモリー使用量に基づくワーカーあたりの最大 Hosted Control Plane 数 | 9.4 | 18.8 | ワーカーのメモリー (GiB) ÷ (アイドル状態のメモリー使用率の測定値 11.1 + (QPS ターゲットレート ÷ 1000) x QPS 増分 1000 あたりのメモリー使用率の測定値 2.5) |

| ノードごとの Pod の制限に基づくワーカーごとの最大 Hosted Control Plane | 6.7 | 6.7 |

500 |

| 前述の最大値の中の最小値 | 5.4 | 6.7 | |

| 仮想 CPU の制限要因 |

| ||

| 管理クラスター内の Hosted Control Plane の最大数 | 16 | 20 | 前述の各最大値の最小値 x 3 control-plane 用ワーカー |

| 名前 | 説明 |

|

| 高可用性 Hosted Control Plane のリソース要求に基づく、クラスターがホストできる Hosted Control Plane の推定最大数。 |

|

| すべての Hosted Control Plane がクラスターの Kube API サーバーに約 50 QPS を送信する場合、クラスターがホストできる Hosted Control Plane の推定最大数。 |

|

| すべての Hosted Control Plane がクラスターの Kube API サーバーに約 1000 QPS を送信する場合、クラスターがホストできる Hosted Control Plane の推定最大数。 |

|

| すべての Hosted Control Plane がクラスターの Kube API サーバーに約 2000 QPS を送信する場合、クラスターがホストできる Hosted Control Plane の推定最大数。 |

|

| Hosted Control Plane の既存の平均 QPS に基づいて、クラスターがホストできる Hosted Control Plane の推定最大数。アクティブな Hosted Control Plane がない場合、QPS が低くなることが予想されます。 |

3.3. リソース使用率測定値のオーバーライド

リソース使用率のベースライン測定値のセットは、ホステッドクラスターごとに異なる場合があります。

3.3.1. ホステッドクラスターのリソース使用率測定値のオーバーライド

リソース使用率の測定値は、クラスターのワークロードの種類とペースに基づいてオーバーライドできます。

手順

次のコマンドを実行して、

ConfigMapリソースを作成します。$ oc create -f <your-config-map-file.yaml><your-config-map-file.yaml>はhcp-sizing-baselineconfig map を含む YAML ファイルの名前に置き換えます。local-clusternamespace にhcp-sizing-baselineconfig map を作成し、オーバーライドする測定値を指定します。config map は、次の YAML ファイルのようになります。kind: ConfigMap apiVersion: v1 metadata: name: hcp-sizing-baseline namespace: local-cluster data: incrementalCPUUsagePer1KQPS: "9.0" memoryRequestPerHCP: "18" minimumQPSPerHCP: "50.0"以下のコマンドを実行して

hypershift-addon-agentデプロイメントを削除し、hypershift-addon-agentPod を再起動します。$ oc delete deployment hypershift-addon-agent \ -n open-cluster-management-agent-addon

検証

hypershift-addon-agentPod ログを監視します。次のコマンドを実行して、オーバーライドされた測定値が config map 内で更新されていることを確認します。$ oc logs hypershift-addon-agent -n open-cluster-management-agent-addonログは以下の出力のようになります。

出力例

2024-01-05T19:41:05.392Z INFO agent.agent-reconciler agent/agent.go:793 setting cpuRequestPerHCP to 5 2024-01-05T19:41:05.392Z INFO agent.agent-reconciler agent/agent.go:802 setting memoryRequestPerHCP to 18 2024-01-05T19:53:54.070Z INFO agent.agent-reconciler agent/hcp_capacity_calculation.go:141 The worker nodes have 12.000000 vCPUs 2024-01-05T19:53:54.070Z INFO agent.agent-reconciler agent/hcp_capacity_calculation.go:142 The worker nodes have 49.173369 GB memoryオーバーライドされた測定値が

hcp-sizing-baselineconfig map で適切に更新されない場合、hypershift-addon-agentPod ログに次のエラーメッセージが表示されることがあります。エラーの例

2024-01-05T19:53:54.052Z ERROR agent.agent-reconciler agent/agent.go:788 failed to get configmap from the hub. Setting the HCP sizing baseline with default values. {"error": "configmaps \"hcp-sizing-baseline\" not found"}

3.3.2. メトリクスサービスモニタリングの無効化

hypershift-addon マネージドクラスターアドオンを有効にすると、メトリクスサービスモニタリングがデフォルトで設定され、OpenShift Container Platform モニタリングが hypershift-addon からメトリクスを収集できるようになります。

手順

次の手順を実行して、メトリクスサービスの監視を無効にできます。

次のコマンドを実行して、ハブクラスターにログインします。

$ oc login次のコマンドを実行して、

hypershift-addon-deploy-configアドオンのデプロイメント設定の仕様を編集します。$ oc edit addondeploymentconfig hypershift-addon-deploy-config \ -n multicluster-engine次の例に示すように、

disableMetrics=trueカスタマイズ変数を仕様に追加します。apiVersion: addon.open-cluster-management.io/v1alpha1 kind: AddOnDeploymentConfig metadata: name: hypershift-addon-deploy-config namespace: multicluster-engine spec: customizedVariables: - name: hcMaxNumber value: "80" - name: hcThresholdNumber value: "60" - name: disableMetrics1 value: "true"- 1

- カスタマイズ変数

disableMetrics=trueは、新規および既存のhypershift-addonマネージドクラスターアドオンのメトリクスサービス監視を無効にします。

次のコマンドを実行して、設定の仕様に変更を適用します。

$ oc apply -f <filename>.yaml

3.4. Hosted Control Plane のコマンドラインインターフェイスのインストール

Hosted Control Plane のコマンドラインインターフェイスである hcp は、Hosted Control Plane の使用を開始するために使用できるツールです。管理や設定などの Day 2 運用には、GitOps や独自の自動化ツールを使用してください。

3.4.1. ターミナルからの Hosted Control Plane コマンドラインインターフェイスのインストール

ターミナルから、Hosted Control Plane のコマンドラインインターフェイス (CLI) である hcp をインストールできます。

前提条件

- OpenShift Container Platform クラスターに multicluster engine for Kubernetes Operator 2.5 がインストールされている。multicluster engine Operator は、Red Hat Advanced Cluster Management をインストールすると自動的にインストールされます。Red Hat Advanced Cluster Management を使用せずに、OpenShift Container Platform OperatorHub から multicluster engine Operator を Operator としてインストールすることもできます。

手順

次のコマンドを実行して、

hcpバイナリーをダウンロードするための URL を取得します。$ oc get ConsoleCLIDownload hcp-cli-download -o json | jq -r ".spec"次のコマンドを実行して

hcpバイナリーをダウンロードします。$ wget <hcp_cli_download_url>1 - 1

hcp_cli_download_urlは、前の手順で取得した URL に置き換えます。

次のコマンドを実行して、ダウンロードしたアーカイブを解凍します。

$ tar xvzf hcp.tar.gz次のコマンドを実行して、

hcpバイナリーファイルを実行可能にします。$ chmod +x hcp次のコマンドを実行して、

hcpバイナリーファイルをパス内のディレクトリーに移動します。$ sudo mv hcp /usr/local/bin/.

Mac コンピューターに CLI をダウンロードすると、hcp バイナリーファイルに関する警告が表示される場合があります。バイナリーファイルを実行できるようにするには、セキュリティー設定を調整する必要があります。

検証

次のコマンドを実行して、使用可能なパラメーターのリストが表示されることを確認します。

$ hcp create cluster <platform> --help1 - 1

hcp create clusterコマンドを使用すると、ホステッドクラスターを作成および管理できます。サポートされているプラットフォームは、aws、agent、およびkubevirtです。

3.4.2. Web コンソールを使用した Hosted Control Plane コマンドラインインターフェイスのインストール

OpenShift Container Platform Web コンソールを使用して、Hosted Control Plane のコマンドラインインターフェイス (CLI) である hcp をインストールできます。

前提条件

- OpenShift Container Platform クラスターに multicluster engine for Kubernetes Operator 2.5 がインストールされている。multicluster engine Operator は、Red Hat Advanced Cluster Management をインストールすると自動的にインストールされます。Red Hat Advanced Cluster Management を使用せずに、OpenShift Container Platform OperatorHub から multicluster engine Operator を Operator としてインストールすることもできます。

手順

- OpenShift Container Platform Web コンソールから、Help アイコン → Command Line Tools をクリックします。

- お使いのプラットフォーム用の Download hcp CLI をクリックします。

次のコマンドを実行して、ダウンロードしたアーカイブを解凍します。

$ tar xvzf hcp.tar.gz次のコマンドを実行して、バイナリーファイルを実行可能にします。

$ chmod +x hcp次のコマンドを実行して、バイナリーファイルをパス内のディレクトリーに移動します。

$ sudo mv hcp /usr/local/bin/.

Mac コンピューターに CLI をダウンロードすると、hcp バイナリーファイルに関する警告が表示される場合があります。バイナリーファイルを実行できるようにするには、セキュリティー設定を調整する必要があります。

検証

次のコマンドを実行して、使用可能なパラメーターのリストが表示されることを確認します。

$ hcp create cluster <platform> --help1 - 1

hcp create clusterコマンドを使用すると、ホステッドクラスターを作成および管理できます。サポートされているプラットフォームは、aws、agent、およびkubevirtです。

3.4.3. コンテンツゲートウェイを使用した Hosted Control Plane コマンドラインインターフェイスのインストール

コンテンツゲートウェイを使用して、Hosted Control Plane のコマンドラインインターフェイス (CLI) である hcp をインストールできます。

前提条件

- OpenShift Container Platform クラスターに multicluster engine for Kubernetes Operator 2.5 がインストールされている。multicluster engine Operator は、Red Hat Advanced Cluster Management をインストールすると自動的にインストールされます。Red Hat Advanced Cluster Management を使用せずに、OpenShift Container Platform OperatorHub から multicluster engine Operator を Operator としてインストールすることもできます。

手順

-

コンテンツゲートウェイ に移動し、

hcpバイナリーをダウンロードします。 次のコマンドを実行して、ダウンロードしたアーカイブを解凍します。

$ tar xvzf hcp.tar.gz次のコマンドを実行して、

hcpバイナリーファイルを実行可能にします。$ chmod +x hcp次のコマンドを実行して、

hcpバイナリーファイルをパス内のディレクトリーに移動します。$ sudo mv hcp /usr/local/bin/.

Mac コンピューターに CLI をダウンロードすると、hcp バイナリーファイルに関する警告が表示される場合があります。バイナリーファイルを実行できるようにするには、セキュリティー設定を調整する必要があります。

検証

次のコマンドを実行して、使用可能なパラメーターのリストが表示されることを確認します。

$ hcp create cluster <platform> --help1 - 1

hcp create clusterコマンドを使用すると、ホステッドクラスターを作成および管理できます。サポートされているプラットフォームは、aws、agent、およびkubevirtです。

3.5. ホステッドクラスターのワークロードの分散

OpenShift Container Platform の Hosted Control Plane を初めて使用する前に、ホステッドクラスターの Pod をインフラストラクチャーノードにスケジュールできるように、ノードを適切にラベル付けする必要があります。また、ノードのラベリングは以下の理由で重要です。

-

高可用性と適切なワークロードのデプロイメントを確保するため。たとえば、コントロールプレーンのワークロードが OpenShift Container Platform サブスクリプションにカウントされるのを回避するために、

node-role.kubernetes.io/infraラベルを設定できます。 - コントロールプレーンのワークロードが管理クラスター内の他のワークロードから分離されるようにするため。

コントロールプレーンのワークロードを、デプロイメントに応じた適切なマルチテナンシー分散レベルで設定するため。分散レベルには次のものがあります。

- すべて共有: ホステッドクラスターのコントロールプレーンを、コントロールプレーン用に指定された任意のノードで実行できます。

- サービングの分離を要求: 専用のノードでサービング Pod を要求します。

- 共有なし: すべてのコントロールプレーンに専用のノードを提供します。

1 つのホステッドクラスターに専用のノードを提供する方法の詳細は、「管理クラスターノードのラベル付け」を参照してください。

ワークロードには管理クラスターを使用しないでください。ワークロードは、コントロールプレーンが実行されるノード上で実行してはなりません。

3.5.1. 管理クラスターノードのラベル付け

Hosted Control Plane をデプロイするには、適切なノードのラベル付けを行う必要があります。

管理クラスターの管理者は、管理クラスターノードで次のラベルと taint を使用して、コントロールプレーンのワークロードをスケジュールします。

-

hypershift.openshift.io/control-plane: true: このラベルとテイントを使用して、Hosted Control Plane ワークロードの実行専用にノードを割り当てます。値をtrueに設定すると、コントロールプレーンノードが他のコンポーネント (管理クラスターのインフラストラクチャーコンポーネントや誤ってデプロイされたその他のワークロードなど) と共有されるのを回避できます。 -

hypershift.openshift.io/cluster: ${HostedControlPlane Namespace}: ノードを単一のホステッドクラスター専用にする場合は、このラベルとテイントを使用します。

コントロールプレーン Pod をホストするノードに以下のラベルを適用します。

-

node-role.kubernetes.io/infra: このラベルを使用して、サブスクリプションにコントロールプレーンワークロード数が割り当てられないようにします。 topology.kubernetes.io/zone: このラベルを管理クラスターノードで使用して、障害ドメイン全体に高可用性クラスターをデプロイします。ゾーンは、ゾーンが設定されているノードの場所、ラック名、またはホスト名である場合があります。たとえば、管理クラスターには、worker-1a、worker-1b、worker-2a、およびworker-2bのノードがあります。worker-1aとworker-1bノードはrack1にあり、worker-2aノードと worker-2b ノードはrack2にあります。各ラックをアベイラビリティゾーンとして使用するには、次のコマンドを入力します。$ oc label node/worker-1a node/worker-1b topology.kubernetes.io/zone=rack1$ oc label node/worker-2a node/worker-2b topology.kubernetes.io/zone=rack2

ホステッドクラスターの Pod には許容範囲があり、スケジューラーはアフィニティールールを使用して Pod をスケジュールします。Pod は、control-plane と Pod の cluster のテイントを許容します。スケジューラーは、hypershift.openshift.io/control-plane および hypershift.openshift.io/cluster: ${HostedControlPlane Namespace} でラベル付けされたノードへの Pod のスケジューリングを優先します。

ControllerAvailabilityPolicy オプションには、HighlyAvailable を使用します。これは、Hosted Control Plane のコマンドラインインターフェイス (hcp) がデプロイするデフォルト値です。このオプションを使用する場合は、topology.kubernetes.io/zone をトポロジーキーとして設定することで、別々の障害ドメインにまたがるホステッドクラスター内の各デプロイメントに対して Pod をスケジュールできます。別々の障害ドメインにまたがるホステッドクラスター内のデプロイメントに対する Pod のスケジュールは、高可用性コントロールプレーンでのみ可能です。

手順

ホステッドクラスターがその Pod をインフラストラクチャーノードにスケジュールすることを要求できるようにするには、次の例に示すように HostedCluster.spec.nodeSelector を設定します。

spec:

nodeSelector:

node-role.kubernetes.io/infra: ""こうすることで、各ホステッドクラスターの Hosted Control Plane が適格なインフラストラクチャーノードワークロードとなり、基盤となる OpenShift Container Platform ノードに資格を与える必要がなくなります。

3.5.2. 優先クラス

4 つの組み込み優先クラスは、ホステッドクラスター Pod の優先順位とプリエンプションに影響を与えます。管理クラスター内に Pod は、次の上位から下位の順序で作成できます。

-

hypershift-operator: HyperShift Operator Pod。 -

hypershift-etcd: etcd 用の Pod。 -

hypershift-api-critical: API 呼び出しとリソース許可が成功するために必要な Pod。これらの Pod には、kube-apiserver、集約 API サーバー、Web フックなどの Pod が含まれます。 -

hypershift-control-plane: API クリティカルではないものの、クラスターバージョンの Operator など、高い優先順位が必要なコントロールプレーン内の Pod。

3.5.3. カスタムの taint と toleration

デフォルトでは、ホステッドクラスターの Pod は、control-plane および cluster taint を許容します。ただし、HostedCluster.spec.tolerations を設定することで、ホステッドクラスターがホステッドクラスターごとにこれらの taint を許容できるように、ノードでカスタムの taint を使用することもできます。

ホステッドクラスターの toleration を渡す機能は、テクノロジープレビュー機能です。テクノロジープレビュー機能は、Red Hat 製品のサービスレベルアグリーメント (SLA) の対象外であり、機能的に完全ではないことがあります。Red Hat は、実稼働環境でこれらを使用することを推奨していません。テクノロジープレビュー機能は、最新の製品機能をいち早く提供して、開発段階で機能のテストを行い、フィードバックを提供していただくことを目的としています。

Red Hat のテクノロジープレビュー機能のサポート範囲に関する詳細は、以下のリンクを参照してください。

設定例

spec:

tolerations:

- effect: NoSchedule

key: kubernetes.io/custom

operator: Exists

hcp CLI の引数 --tolerations を使用して、クラスターを作成するときに、ホステッドクラスターに toleration を設定することもできます。

CLI 引数の例

--toleration="key=kubernetes.io/custom,operator=Exists,effect=NoSchedule"

ホステッドクラスターごとにホステッドクラスター Pod の配置を細かく制御するには、カスタムの toleration を nodeSelectors とともに使用します。ホステッドクラスターのグループを同じ場所に配置し、他のホステッドクラスターから分離することができます。ホステッドクラスターをインフラノードとコントロールプレーンノードに配置することもできます。

ホステッドクラスターの toleration は、コントロールプレーンの Pod にのみ適用されます。管理クラスターで実行される他の Pod や、仮想マシンを実行する Pod などのインフラストラクチャー関連の Pod を設定するには、別のプロセスを使用する必要があります。

3.5.4. コントロールプレーンの分離

Hosted Control Plane を設定して、ネットワークトラフィックやコントロールプレーン Pod を分離できます。

3.5.4.1. ネットワークポリシーの分離

各 Hosted Control Plane は、専用の Kubernetes namespace で稼働するように指定されます。デフォルトでは、Kubernetes namespace はすべてのネットワークトラフィックを拒否します。

次のネットワークトラフィックは、Kubernetes Container Network Interface (CNI) によって適用されるネットワークポリシーによって許可されます。

- 同じ namespace (テナント内) での Ingress Pod 間通信

-

テナントのホストされた

kube-apiserverPod へのポート 6443 の Ingress -

network.openshift.io/policy-group: monitoringラベルを持つ管理クラスターの Kubernetes namespace からのメトリクススクレイピングは、監視用に許可されます。

3.5.4.2. コントロールプレーン Pod の分離

各 Hosted Control Plane Pod は、ネットワークポリシーに加えて、restricted セキュリティーコンテキスト制約を使用して実行されます。このポリシーは、すべてのホスト機能へのアクセスを拒否し、お客様のコントロールプレーンをホストする各 namespace に一意に割り当てられた UID と SELinux コンテキストを使用して Pod を実行することを要求します。

このポリシーにより、次の制約が確実に実行されます。

- Pod は特権付き Pod として実行できません。

- Pod はホストディレクトリーボリュームをマウントできません。

- Pod は、事前に割り当てられた UID の範囲内のユーザーとして実行する必要があります。

- Pod は、事前に割り当てられた MCS ラベルを使用して実行する必要があります。

- Pod はホストネットワークの namespace にアクセスできません。

- Pod はホストネットワークのポートを公開できません。

- Pod はホストの PID namespace にアクセスできません。

-

Pod はデフォルトで Linux ケイパビリティー

KILL、MKNOD、SETUID、およびSETGIDをドロップします。

各管理クラスターのワーカーノード上の管理コンポーネント (kubelet や crio など) は、Hosted Control Plane を支える Pod の SELinux コンテキストからアクセスできない SELinux ラベルによって保護されます。

主要なプロセスとソケットには、次の SELinux ラベルが使用されます。

-

kubelet:

system_u:system_r:unconfined_service_t:s0 -

crio:

system_u:system_r:container_runtime_t:s0 -

crio.sock:

system_u:object_r:container_var_run_t:s0 -

<ユーザーコンテナープロセスの例>:

system_u:system_r:container_t:s0:c14,c24

3.6. Hosted Control Plane 機能の有効化または無効化

Hosted Control Plane 機能と hypershift-addon マネージドクラスターアドオンは、デフォルトで有効になっています。機能を無効にする場合、または無効にした後に手動で有効にする場合は、次の手順を参照してください。

3.6.1. Hosted Control Plane 機能の手動での有効化

Hosted Control Plane を手動で有効にする必要がある場合は、次の手順を実行します。

手順

次のコマンドを実行して機能を有効にします。

$ oc patch mce multiclusterengine --type=merge -p \ '{"spec":{"overrides":{"components":[{"name":"hypershift","enabled": true}]}}}'1 - 1

- デフォルトの

MultiClusterEngineリソースインスタンス名はmulticlusterengineですが、$ oc get mceコマンドを実行し、クラスターからMultiClusterEngine名を取得できます。

次のコマンドを実行して、

hypershiftおよびhypershift-local-hosting機能がMultiClusterEngineカスタムリソースで有効になっていることを確認します。$ oc get mce multiclusterengine -o yaml1 - 1

- デフォルトの

MultiClusterEngineリソースインスタンス名はmulticlusterengineですが、$ oc get mceコマンドを実行し、クラスターからMultiClusterEngine名を取得できます。

出力例

apiVersion: multicluster.openshift.io/v1 kind: MultiClusterEngine metadata: name: multiclusterengine spec: overrides: components: - name: hypershift enabled: true - name: hypershift-local-hosting enabled: true

3.6.1.1. local-cluster の hypershift-addon マネージドクラスターアドオンを手動で有効にする

Hosted Control Plane 機能を有効にすると、hypershift-addon マネージドクラスターアドオンが自動的に有効になります。hypershift-addon マネージドクラスターアドオンを手動で有効にする必要がある場合は、次の手順を実行して hypershift-addon を使用し、HyperShift Operator を local-cluster にインストールします。

手順

次の例のようなファイルを作成して、

hypershift-addonという名前のManagedClusterAddonアドオンを作成します。apiVersion: addon.open-cluster-management.io/v1alpha1 kind: ManagedClusterAddOn metadata: name: hypershift-addon namespace: local-cluster spec: installNamespace: open-cluster-management-agent-addon以下のコマンドを実行してこのファイルを適用します。

$ oc apply -f <filename>filenameは、作成したファイル名に置き換えます。次のコマンドを実行して、

hypershift-addonマネージドクラスターアドオンがインストールされていることを確認します。$ oc get managedclusteraddons -n local-cluster hypershift-addonアドオンがインストールされている場合、出力は以下の例のようになります。

NAME AVAILABLE DEGRADED PROGRESSING hypershift-addon True

hypershift-addon マネージドクラスターアドオンがインストールされ、ホスティングクラスターを使用してホステッドクラスターを作成および管理できるようになります。

3.6.2. Hosted Control Plane 機能の無効化

HyperShift Operator をアンインストールして、Hosted Control Plane 機能を無効にすることができます。Hosted Control Plane 機能を無効にする場合は、ホステッドクラスターの管理 のトピックで説明されているように、multicluster engine Operator のホステッドクラスターとマネージドクラスターリソースを破棄する必要があります。

3.6.2.1. HyperShift Operator のアンインストール

HyperShift Operator をアンインストールし、local-cluster から hypershift-addon を無効にするには、以下の手順を実行します。

手順

以下のコマンドを実行して、ホステッドクラスターが実行されていないことを確認します。

$ oc get hostedcluster -A重要ホステッドクラスターが実行中の場合、

hypershift-addonが無効になっていても、HyperShift Operator はアンインストールされません。以下のコマンドを実行して

hypershift-addonを無効にします。$ oc patch mce multiclusterengine --type=merge -p \1 '{"spec":{"overrides":{"components":[{"name":"hypershift-local-hosting","enabled": false}]}}}'- 1

- デフォルトの

MultiClusterEngineリソースインスタンス名はmulticlusterengineですが、$ oc get mceコマンドを実行し、クラスターからMultiClusterEngine名を取得できます。

注記hypershift-addonを無効にした後、multicluster engine Operator コンソールからlocal-clusterのhypershift-addonを無効にすることもできます。

3.6.2.2. Hosted Control Plane 機能の無効化

Hosted Control Plane 機能を無効にするには、次の手順を実行します。

前提条件

- HyperShift Operator をアンインストールした。詳細は、「HyperShift Operator のアンインストール」を参照してください。

手順

次のコマンドを実行して、Hosted Control Plane 機能を無効にします。

$ oc patch mce multiclusterengine --type=merge -p \1 '{"spec":{"overrides":{"components":[{"name":"hypershift","enabled": false}]}}}'- 1

- デフォルトの

MultiClusterEngineリソースインスタンス名はmulticlusterengineですが、$ oc get mceコマンドを実行し、クラスターからMultiClusterEngine名を取得できます。

次のコマンドを実行すると、

MultiClusterEngineカスタムリソースでhypershiftおよびhypershift-local-hosting機能が無効になっていることを確認できます。$ oc get mce multiclusterengine -o yaml1 - 1

- デフォルトの

MultiClusterEngineリソースインスタンス名はmulticlusterengineですが、$ oc get mceコマンドを実行し、クラスターからMultiClusterEngine名を取得できます。

hypershiftとhypershift-local-hostingのenabled:フラグがfalseに設定されている次の例を参照してください。apiVersion: multicluster.openshift.io/v1 kind: MultiClusterEngine metadata: name: multiclusterengine spec: overrides: components: - name: hypershift enabled: false - name: hypershift-local-hosting enabled: false

第4章 Hosted Control Plane のデプロイ

4.1. AWS への Hosted Control Plane のデプロイ

ホステッドクラスター は、API エンドポイントとコントロールプレーンが管理クラスターでホストされている OpenShift Container Platform クラスターです。ホステッドクラスターには、コントロールプレーンとそれに対応するデータプレーンが含まれます。オンプレミスで Hosted Control Plane を設定するには、管理クラスターに multicluster engine for Kubernetes Operator をインストールする必要があります。hypershift-addon マネージドクラスターアドオンを使用して既存のマネージドクラスターに HyperShift Operator をデプロイすると、そのクラスターを管理クラスターとして有効にして、ホステッドクラスターの作成を開始できます。hypershift-addon マネージドクラスターアドオンは、local-cluster マネージドクラスターでデフォルトで有効になっています。

ホステッドクラスターは、multicluster engine Operator のコンソールか、Hosted Control Plane のコマンドラインインターフェイス (CLI) である hcp を使用して作成できます。ホステッドクラスターは、マネージドクラスターとして自動的にインポートされます。ただし、この multicluster engine Operator への自動インポート機能を無効にする こともできます。

4.1.1. AWS への Hosted Control Plane のデプロイの準備

Amazon Web Services (AWS) に Hosted Control Plane をデプロイする準備をする際には、次の情報を考慮してください。

- 各ホステッドクラスターの名前がクラスター全体で一意である。multicluster engine Operator によってホステッドクラスターを管理するには、ホステッドクラスター名を既存のマネージドクラスターと同じにすることはできません。

-

ホステッドクラスター名として

clustersを使用しないでください。 - 管理クラスターとワーカーは、Hosted Control Plane の同じプラットフォーム上で実行してください。

- ホステッドクラスターは、multicluster engine Operator のマネージドクラスターの namespace には作成できない。

4.1.1.1. 管理クラスターを設定するための前提条件

管理クラスターを設定するには、次の前提条件を満たす必要があります。

- OpenShift Container Platform クラスターに multicluster engine for Kubernetes Operator 2.5 以降がインストールされている。multicluster engine Operator は、Red Hat Advanced Cluster Management (RHACM) をインストールすると、自動的にインストールされます。multicluster engine Operator は、OpenShift Container Platform OperatorHub から Operator として RHACM なしでインストールすることもできます。

multicluster engine Operator のマネージド OpenShift Container Platform クラスターが少なくとも 1 つある。multicluster engine Operator バージョン 2.5 以降では、

local-clusterが自動的にインポートされます。次のコマンドを実行して、ハブクラスターの状態を確認できます。$ oc get managedclusters local-cluster-

awsコマンドラインインターフェイス (CLI) がインストールされている。 -

Hosted Control Plane の CLI である

hcpがインストールされている。

4.1.2. hcp CLI を使用して AWS 上のホステッドクラスターにアクセスする

hcp コマンドラインインターフェイス (CLI) を使用して kubeconfig ファイルを生成することで、ホステッドクラスターにアクセスできます。

手順

次のコマンドを入力して、

kubeconfigファイルを生成します。$ hcp create kubeconfig --namespace <hosted_cluster_namespace> \ --name <hosted_cluster_name> > <hosted_cluster_name>.kubeconfigkubeconfigファイルを保存した後、次のコマンドを入力してホステッドクラスターにアクセスできます。$ oc --kubeconfig <hosted_cluster_name>.kubeconfig get nodes

4.1.3. Amazon Web Services S3 バケットと S3 OIDC シークレットの作成

Amazon Web Services (AWS) でホステッドクラスターを作成して管理するには、S3 バケットと S3 OIDC シークレットを作成する必要があります。

手順

次のコマンドを実行して、クラスターの OIDC 検出ドキュメントをホストするためのパブリックアクセスを持つ S3 バケットを作成します。

$ aws s3api create-bucket --bucket <bucket_name> \1 --create-bucket-configuration LocationConstraint=<region> \2 --region <region>3 $ aws s3api delete-public-access-block --bucket <bucket_name>1 - 1

<bucket_name>は、作成する S3 バケットの名前に置き換えます。

$ echo '{ "Version": "2012-10-17", "Statement": [ { "Effect": "Allow", "Principal": "*", "Action": "s3:GetObject", "Resource": "arn:aws:s3:::<bucket_name>/*"1 } ] }' | envsubst > policy.json- 1

<bucket_name>は、作成する S3 バケットの名前に置き換えます。

$ aws s3api put-bucket-policy --bucket <bucket_name> \1 --policy file://policy.json- 1

<bucket_name>は、作成する S3 バケットの名前に置き換えます。

注記Mac コンピューターを使用している場合は、ポリシーを機能させるためにバケット名をエクスポートする必要があります。

-

HyperShift Operator 用に

hypershift-operator-oidc-provider-s3-credentialsという名前の OIDC S3 シークレットを作成します。 -

シークレットを

local-clusternamespace に保存します。 次の表を参照して、シークレットに次のフィールドが含まれていることを確認します。

Expand 表4.1 AWS シークレットの必須フィールド フィールド名 説明 bucketホステッドクラスターの OIDC 検出ドキュメントをホストするためのパブリックアクセスを備えた S3 バケットが含まれています。

credentialsバケットにアクセスできる

defaultプロファイルの認証情報を含むファイルへの参照。デフォルトでは、HyperShift はdefaultプロファイルのみを使用してbucketを操作します。regionS3 バケットのリージョンを指定します。

AWS シークレットを作成するには、次のコマンドを実行します。

$ oc create secret generic <secret_name> \ --from-file=credentials=<path>/.aws/credentials \ --from-literal=bucket=<s3_bucket> \ --from-literal=region=<region> \ -n local-cluster注記シークレットの障害復旧バックアップは自動的に有効になりません。障害復旧用に

hypershift-operator-oidc-provider-s3-credentialsシークレットのバックアップを有効にするラベルを追加するには、次のコマンドを実行します。$ oc label secret hypershift-operator-oidc-provider-s3-credentials \ -n local-cluster cluster.open-cluster-management.io/backup=true

4.1.4. ホステッドクラスター用のルーティング可能なパブリックゾーンの作成

ホステッドクラスター内のアプリケーションにアクセスするには、ルーティング可能なパブリックゾーンを設定する必要があります。パブリックゾーンが存在する場合は、この手順を省略します。省略しないと、パブリックゾーンによって既存の機能に影響が生じます。

手順

DNS レコードのルーティング可能なパブリックゾーンを作成するには、次のコマンドを入力します。

$ aws route53 create-hosted-zone \ --name <basedomain> \1 --caller-reference $(whoami)-$(date --rfc-3339=date)- 1

<basedomain>は、ベースドメイン (例:www.example.com) に置き換えます。

4.1.5. AWS IAM ロールと STS 認証情報の作成

Amazon Web Services (AWS) でホステッドクラスターを作成する前に、AWS IAM ロールと STS 認証情報を作成する必要があります。

手順

次のコマンドを実行して、ユーザーの Amazon Resource Name (ARN) を取得します。

$ aws sts get-caller-identity --query "Arn" --output text出力例

arn:aws:iam::1234567890:user/<aws_username>この出力は、次のステップで

<arn>の値として使用します。ロールの信頼関係設定を含む JSON ファイルを作成します。以下の例を参照してください。

{ "Version": "2012-10-17", "Statement": [ { "Effect": "Allow", "Principal": { "AWS": "<arn>"1 }, "Action": "sts:AssumeRole" } ] }- 1

<arn>は、前のステップでメモしたユーザーの ARN に置き換えます。

次のコマンドを実行して、Identity and Access Management (IAM) ロールを作成します。

$ aws iam create-role \ --role-name <name> \1 --assume-role-policy-document file://<file_name>.json \2 --query "Role.Arn"出力例

arn:aws:iam::820196288204:role/myroleロールの次の権限ポリシーを含む

policy.jsonという名前の JSON ファイルを作成します。{ "Version": "2012-10-17", "Statement": [ { "Sid": "EC2", "Effect": "Allow", "Action": [ "ec2:CreateDhcpOptions", "ec2:DeleteSubnet", "ec2:ReplaceRouteTableAssociation", "ec2:DescribeAddresses", "ec2:DescribeInstances", "ec2:DeleteVpcEndpoints", "ec2:CreateNatGateway", "ec2:CreateVpc", "ec2:DescribeDhcpOptions", "ec2:AttachInternetGateway", "ec2:DeleteVpcEndpointServiceConfigurations", "ec2:DeleteRouteTable", "ec2:AssociateRouteTable", "ec2:DescribeInternetGateways", "ec2:DescribeAvailabilityZones", "ec2:CreateRoute", "ec2:CreateInternetGateway", "ec2:RevokeSecurityGroupEgress", "ec2:ModifyVpcAttribute", "ec2:DeleteInternetGateway", "ec2:DescribeVpcEndpointConnections", "ec2:RejectVpcEndpointConnections", "ec2:DescribeRouteTables", "ec2:ReleaseAddress", "ec2:AssociateDhcpOptions", "ec2:TerminateInstances", "ec2:CreateTags", "ec2:DeleteRoute", "ec2:CreateRouteTable", "ec2:DetachInternetGateway", "ec2:DescribeVpcEndpointServiceConfigurations", "ec2:DescribeNatGateways", "ec2:DisassociateRouteTable", "ec2:AllocateAddress", "ec2:DescribeSecurityGroups", "ec2:RevokeSecurityGroupIngress", "ec2:CreateVpcEndpoint", "ec2:DescribeVpcs", "ec2:DeleteSecurityGroup", "ec2:DeleteDhcpOptions", "ec2:DeleteNatGateway", "ec2:DescribeVpcEndpoints", "ec2:DeleteVpc", "ec2:CreateSubnet", "ec2:DescribeSubnets" ], "Resource": "*" }, { "Sid": "ELB", "Effect": "Allow", "Action": [ "elasticloadbalancing:DeleteLoadBalancer", "elasticloadbalancing:DescribeLoadBalancers", "elasticloadbalancing:DescribeTargetGroups", "elasticloadbalancing:DeleteTargetGroup" ], "Resource": "*" }, { "Sid": "IAMPassRole", "Effect": "Allow", "Action": "iam:PassRole", "Resource": "arn:*:iam::*:role/*-worker-role", "Condition": { "ForAnyValue:StringEqualsIfExists": { "iam:PassedToService": "ec2.amazonaws.com" } } }, { "Sid": "IAM", "Effect": "Allow", "Action": [ "iam:CreateInstanceProfile", "iam:DeleteInstanceProfile", "iam:GetRole", "iam:UpdateAssumeRolePolicy", "iam:GetInstanceProfile", "iam:TagRole", "iam:RemoveRoleFromInstanceProfile", "iam:CreateRole", "iam:DeleteRole", "iam:PutRolePolicy", "iam:AddRoleToInstanceProfile", "iam:CreateOpenIDConnectProvider", "iam:ListOpenIDConnectProviders", "iam:DeleteRolePolicy", "iam:UpdateRole", "iam:DeleteOpenIDConnectProvider", "iam:GetRolePolicy" ], "Resource": "*" }, { "Sid": "Route53", "Effect": "Allow", "Action": [ "route53:ListHostedZonesByVPC", "route53:CreateHostedZone", "route53:ListHostedZones", "route53:ChangeResourceRecordSets", "route53:ListResourceRecordSets", "route53:DeleteHostedZone", "route53:AssociateVPCWithHostedZone", "route53:ListHostedZonesByName" ], "Resource": "*" }, { "Sid": "S3", "Effect": "Allow", "Action": [ "s3:ListAllMyBuckets", "s3:ListBucket", "s3:DeleteObject", "s3:DeleteBucket" ], "Resource": "*" } ] }次のコマンドを実行して、

policy.jsonファイルをロールに割り当てます。$ aws iam put-role-policy \ --role-name <role_name> \1 --policy-name <policy_name> \2 --policy-document file://policy.json3 次のコマンドを実行して、

sts-creds.jsonという名前の JSON ファイル内の STS 認証情報を取得します。$ aws sts get-session-token --output json > sts-creds.jsonsts-creds.jsonファイルの例{ "Credentials": { "AccessKeyId": "<access_key_id", "SecretAccessKey": "<secret_access_key>”, "SessionToken": "<session_token>", "Expiration": "<time_stamp>" } }

4.1.6. Hosted Control Plane 用の AWS PrivateLink の有効化

PrivateLink を使用して Amazon Web Services (AWS) で Hosted Control Plane をプロビジョニングするには、Hosted Control Plane 用の AWS PrivateLink を有効にします。

手順

-

HyperShift Operator の AWS 認証情報シークレットを作成し、

hypershift-operator-private-link-credentialsという名前を付けます。このシークレットは、管理クラスターとして使用されているマネージドクラスターの namespace であるマネージドクラスター namespace に配置する必要があります。local-clusterを使用した場合は、local-clusternamespace にシークレットを作成します。 - シークレットに必要なフィールドが含まれることを確認するには、以下の表を参照してください。

| フィールド名 | 説明 | 任意または必須 |

|---|---|---|

|

| Private Link で使用するリージョン | 必須 |

|

| 認証情報アクセスキー ID。 | 必須 |

|

| 認証情報アクセスキーのシークレット。 | 必須 |

AWS シークレットを作成するには、次のコマンドを実行します。

$ oc create secret generic <secret_name> \

--from-literal=aws-access-key-id=<aws_access_key_id> \

--from-literal=aws-secret-access-key=<aws_secret_access_key> \

--from-literal=region=<region> -n local-cluster

シークレットの障害復旧バックアップは自動的に有効になりません。以下のコマンドを実行して、障害復旧用に hypershift-operator-private-link-credentials シークレットのバックアップを有効にするラベルを追加します。

$ oc label secret hypershift-operator-private-link-credentials \

-n local-cluster \

cluster.open-cluster-management.io/backup=""4.1.7. AWS 上の Hosted Control Plane 用の外部 DNS を有効にする

Hosted Control Plane では、コントロールプレーンとデータプレーンが分離されています。DNS は、次の 2 つの独立した領域で設定できます。

-

ホステッドクラスター (

*.apps.service-consumer-domain.comなどのドメイン) 内のワークロードの Ingress。 -

サービスプロバイダーのドメイン

*.service-provider-domain.comを介した API または OAuth エンドポイントなど、管理クラスター内のサービスエンドポイントの Ingress。

hostedCluster.spec.dns の入力は、ホステッドクラスター内のワークロードの Ingress を管理します。hostedCluster.spec.services.servicePublishingStrategy.route.hostname の入力は、管理クラスター内のサービスエンドポイントの Ingress を決定します。

外部 DNS は、LoadBalancer または Route の公開タイプを指定し、その公開タイプのホスト名を提供するホステッドクラスター Services の名前レコードを作成します。Private または PublicAndPrivate エンドポイントアクセスタイプを持つホステッドクラスターの場合、APIServer サービスと OAuth サービスのみがホスト名をサポートします。Private ホステッドクラスターの場合、DNS レコードが VPC 内の Virtual Private Cloud (VPC) エンドポイントのプライベート IP アドレスに解決されます。

Hosted Control Plane は、次のサービスを公開します。

-

APIServer -

OIDC

これらのサービスは、HostedCluster 仕様の servicePublishingStrategy フィールドを使用して公開できます。デフォルトでは、servicePublishingStrategy の LoadBalancer および Route タイプの場合、次のいずれかの方法でサービスを公開できます。

-

LoadBalancerタイプのServiceのステータスにあるロードバランサーのホスト名を使用する方法 -

Routeリソースのstatus.hostフィールドを使用する方法

ただし、マネージドサービスのコンテキストで Hosted Control Plane をデプロイすると、これらの方法によって、基盤となる管理クラスターの Ingress サブドメインが公開され、管理クラスターのライフサイクルと障害復旧のオプションが制限される可能性があります。

DNS 間接化が LoadBalancer および Route 公開タイプに階層化されている場合、マネージドサービスオペレーターは、サービスレベルドメインを使用してすべてのパブリックホステッドクラスターサービスを公開できます。このアーキテクチャーでは、DNS 名を新しい LoadBalancer または Route に再マッピングできますが、管理クラスターの Ingress ドメインは公開されません。Hosted Control Plane は、外部 DNS を使用して間接層を実現します。

管理クラスターの hypershift namespace に HyperShift Operator と一緒に external-dns をデプロイできます。外部 DNS は、external-dns.alpha.kubernetes.io/hostname アノテーションを持つ Services または Routes を監視します。このアノテーションは、A レコードなどの Service、または CNAME レコードなどの Route を参照する DNS レコードを作成するために使用されます。

外部 DNS はクラウド環境でのみ使用できます。その他の環境では、DNS とサービスを手動で設定する必要があります。

外部 DNS の詳細は、外部 DNS を参照してください。

4.1.7.1. 前提条件

Amazon Web Services (AWS) で Hosted Control Plane の外部 DNS を設定する前に、次の前提条件を満たす必要があります。

- 外部パブリックドメインを作成した。

- AWS Route53 管理コンソールにアクセスできる。

- Hosted Control Plane 用に AWS PrivateLink を有効にした。

4.1.7.2. Hosted Control Plane の外部 DNS の設定

Hosted Control Plane は、外部 DNS またはサービスレベル DNS を使用してプロビジョニングできます。

-

HyperShift Operator 用の Amazon Web Services (AWS) 認証情報シークレットを作成し、

local-clusternamespace でhypershift-operator-external-dns-credentialsという名前を付けます。 次の表を参照して、シークレットに必須フィールドが含まれていることを確認してください。

Expand 表4.3 AWS シークレットの必須フィールド フィールド名 説明 任意または必須 providerサービスレベル DNS ゾーンを管理する DNS プロバイダー。

必須

domain-filterサービスレベルドメイン。

必須

credentialsすべての外部 DNS タイプをサポートする認証情報ファイル。

AWS キーを使用する場合はオプション

aws-access-key-id認証情報アクセスキー ID。

AWS DNS サービスを使用する場合はオプション

aws-secret-access-key認証情報アクセスキーのシークレット。

AWS DNS サービスを使用する場合はオプション

AWS シークレットを作成するには、次のコマンドを実行します。

$ oc create secret generic <secret_name> \ --from-literal=provider=aws \ --from-literal=domain-filter=<domain_name> \ --from-file=credentials=<path_to_aws_credentials_file> -n local-cluster注記シークレットの障害復旧バックアップは自動的に有効になりません。障害復旧のためにシークレットをバックアップするには、次のコマンドを入力して

hypershift-operator-external-dns-credentialsを追加します。$ oc label secret hypershift-operator-external-dns-credentials \ -n local-cluster \ cluster.open-cluster-management.io/backup=""

4.1.7.3. パブリック DNS ホストゾーンの作成

パブリック DNS ホストゾーンは、パブリックホステッドクラスターを作成するために、External DNS Operator によって使用されます。

外部 DNS ドメインフィルターとして使用するパブリック DNS ホストゾーンを作成できます。AWS Route 53 管理コンソールで次の手順を実行します。

手順

- Route 53 管理コンソールで、Create hosted zone をクリックします。

- Hosted zone configuration ページでドメイン名を入力し、タイプとして Public hosted zone が選択されていることを確認し、Create hosted zone をクリックします。

- ゾーンが作成されたら、Records タブの Value/Route traffic to 列の値をメモします。

- メインドメインで、DNS 要求を委任ゾーンにリダイレクトするための NS レコードを作成します。Value フィールドに、前の手順でメモした値を入力します。

- Create records をクリックします。

次の例のように、新しいサブゾーンにテストエントリーを作成し、

digコマンドでテストして、DNS ホストゾーンが機能していることを確認します。$ dig +short test.user-dest-public.aws.kerberos.com出力例

192.168.1.1LoadBalancerおよびRouteサービスのホスト名を設定するホステッドクラスターを作成するには、次のコマンドを入力します。$ hcp create cluster aws --name=<hosted_cluster_name> \ --endpoint-access=PublicAndPrivate \ --external-dns-domain=<public_hosted_zone> ...1 - 1

<public_hosted_zone>は、作成したパブリックホストゾーンに置き換えます。

ホステッドクラスターの

servicesブロックの例platform: aws: endpointAccess: PublicAndPrivate ... services: - service: APIServer servicePublishingStrategy: route: hostname: api-example.service-provider-domain.com type: Route - service: OAuthServer servicePublishingStrategy: route: hostname: oauth-example.service-provider-domain.com type: Route - service: Konnectivity servicePublishingStrategy: type: Route - service: Ignition servicePublishingStrategy: type: Route

Control Plane Operator は、Services と Routes リソースを作成し、external-dns.alpha.kubernetes.io/hostname のアノテーションを付けます。Services と Routes の場合、Control Plane Operator は、サービスエンドポイントの servicePublishingStrategy フィールドの hostname パラメーターの値を使用します。DNS レコードを作成するには、external-dns デプロイメントなどのメカニズムを使用できます。

サービスレベルの DNS 間接化をパブリックサービスにのみ設定できます。プライベートサービスは hypershift.local プライベートゾーンを使用するため、hostname を設定できません。

次の表は、サービスとエンドポイントの組み合わせに対して hostname を設定することが有効な場合を示しています。

| サービス | Public | PublicAndPrivate | Private |

|---|---|---|---|

|

| Y | Y | N |

|

| Y | Y | N |

|

| Y | N | N |

|

| Y | N | N |

4.1.7.4. AWS 上で外部 DNS を使用してホステッドクラスターを作成する

Amazon Web Services (AWS) で PublicAndPrivate または Public 公開ストラテジーを使用してホステッドクラスターを作成するには、管理クラスターで次のアーティファクトが設定されている必要があります。

- パブリック DNS ホストゾーン

- External DNS Operator

- HyperShift Operator

ホステッドクラスターは、hcp コマンドラインインターフェイス (CLI) を使用してデプロイできます。

手順

管理クラスターにアクセスするには、次のコマンドを入力します。

$ export KUBECONFIG=<path_to_management_cluster_kubeconfig>次のコマンドを入力して、External DNS Operator が実行されていることを確認します。

$ oc get pod -n hypershift -lapp=external-dns出力例

NAME READY STATUS RESTARTS AGE external-dns-7c89788c69-rn8gp 1/1 Running 0 40s外部 DNS を使用してホステッドクラスターを作成するには、次のコマンドを入力します。

$ hcp create cluster aws \ --role-arn <arn_role> \1 --instance-type <instance_type> \2 --region <region> \3 --auto-repair \ --generate-ssh \ --name <hosted_cluster_name> \4 --namespace clusters \ --base-domain <service_consumer_domain> \5 --node-pool-replicas <node_replica_count> \6 --pull-secret <path_to_your_pull_secret> \7 --release-image quay.io/openshift-release-dev/ocp-release:<ocp_release_image> \8 --external-dns-domain=<service_provider_domain> \9 --endpoint-access=PublicAndPrivate10 --sts-creds <path_to_sts_credential_file>11 - 1

- Amazon Resource Name (ARN) を指定します (例:

arn:aws:iam::820196288204:role/myrole)。 - 2

- インスタンスタイプを指定します (例:

m6i.xlarge)。 - 3

- AWS リージョンを指定します (例:

us-east-1)。 - 4

- ホステッドクラスター名を指定します (例:

my-external-aws)。 - 5

- サービスコンシューマーが所有するパブリックホストゾーンを指定します (例:

service-consumer-domain.com)。 - 6

- ノードのレプリカ数を指定します (例:

2)。 - 7

- プルシークレットファイルへのパスを指定します。

- 8

- 使用するサポート対象の OpenShift Container Platform バージョンを指定します (例:

4.19.0-multi)。 - 9

- サービスプロバイダーが所有するパブリックホストゾーンを指定します (例:

service-provider-domain.com)。 - 10

PublicAndPrivateとして設定します。外部 DNS は、PublicまたはPublicAndPrivate設定でのみ使用できます。- 11

- AWS STS 認証情報ファイルへのパスを指定します (例:

/home/user/sts-creds/sts-creds.json)。

4.1.7.5. カスタム DNS 名の定義

クラスター管理者は、ノードのブートストラップとコントロールプレーンの通信に使用される内部エンドポイントとは異なる外部 API DNS 名を持つホステッドクラスターを作成できます。別の DNS 名を定義する理由には、次のようなものがあります。

- 内部ルート CA にバインドされているコントロールプレーン機能を損なうことなく、ユーザー向けの TLS 証明書をパブリック CA が発行したものに置き換えるため。

- スプリットホライズン DNS および NAT のシナリオをサポートするため。

-

スタンドアロンのコントロールプレーンと同様のエクスペリエンスを確保し、正しい

kubeconfigと DNS 設定を使用して、Show Login Commandなどの機能を使用可能にするため。

HostedCluster オブジェクトの kubeAPIServerDNSName パラメーターにドメイン名を入力することで、初期セットアップ時またはインストール後の操作時に DNS 名を定義できます。

前提条件

-

kubeAPIServerDNSNameパラメーターで設定する DNS 名が、有効な TLS 証明書の対象に含まれている。 - 正しいアドレスに到達し、それを指し示す解決可能な DNS 名 URI がある。

手順

HostedClusterオブジェクトの仕様で、kubeAPIServerDNSNameパラメーターとドメインのアドレスを追加し、使用する証明書を指定します (次の例を参照)。#... spec: configuration: apiServer: servingCerts: namedCertificates: - names: - xxx.example.com - yyy.example.com servingCertificate: name: <my_serving_certificate> kubeAPIServerDNSName: <custom_address>1 - 1

kubeAPIServerDNSNameパラメーターの値は、有効でアドレス指定可能なドメインである必要があります。

kubeAPIServerDNSName パラメーターを定義して証明書を指定すると、Control Plane Operator のコントローラーによって custom-admin-kubeconfig という名前の kubeconfig ファイルが作成されます。このファイルは HostedControlPlane namespace に保存されます。証明書はルート CA から生成され、HostedControlPlane namespace によって証明書の有効期限と更新が管理されます。

Control Plane Operator は、HostedControlPlane namespace に CustomKubeconfig という名前の新しい kubeconfig ファイルを報告します。このファイルは、kubeAPIServerDNSName パラメーターで定義された新しいサーバーを使用します。

カスタム kubeconfig ファイルへの参照情報は、HostedCluster オブジェクトの status パラメーター内に CustomKubeconfig という名前で存在しています。CustomKubeConfig パラメーターは任意であり、kubeAPIServerDNSName パラメーターが空でない場合にのみ追加できます。CustomKubeConfig パラメーターを設定すると、そのパラメーターによって、HostedCluster namespace で <hosted_cluster_name>-custom-admin-kubeconfig という名前のシークレットの生成がトリガーされます。このシークレットを使用して HostedCluster API サーバーにアクセスできます。インストール後の操作時に CustomKubeConfig パラメーターを削除すると、関連するすべてのシークレットとステータス参照が削除されます。

カスタム DNS 名の定義はデータプレーンに直接影響しないため、予期されるロールアウトは発生しません。HostedControlPlane namespace は、HyperShift Operator から変更を受け取り、対応するパラメーターを削除します。

HostedCluster オブジェクトの仕様から kubeAPIServerDNSName パラメーターを削除すると、新しく生成されたすべてのシークレットと、CustomKubeconfig 参照がクラスターと status パラメーターから削除されます。

4.1.8. AWS 上でホステッドクラスターを作成する

hcp コマンドラインインターフェイス (CLI) を使用して、Amazon Web Services (AWS) 上にホステッドクラスターを作成できます。

Amazon Web Services (AWS) 上の Hosted Control Plane では、デフォルトで AMD64 ホステッドクラスターを使用します。ただし、Hosted Control Plane を ARM64 ホステッドクラスターで実行することもできます。詳細は、「ARM64 アーキテクチャーでのホステッドクラスターの実行」を参照してください。

ノードプールとホステッドクラスターの互換性のある組み合わせは、次の表を参照してください。

| ホステッドクラスター | ノードプール |

|---|---|

| AMD64 | AMD64 または ARM64 |

| ARM64 | ARM64 または AMD64 |

前提条件

-

Hosted Control Plane の CLI である

hcpを設定した。 -

local-clusterマネージドクラスターを管理クラスターとして有効にした。 - AWS Identity and Access Management (IAM) ロールと AWS Security Token Service (STS) 認証情報を作成した。

手順

AWS 上にホステッドクラスターを作成するには、次のコマンドを実行します。

$ hcp create cluster aws \ --name <hosted_cluster_name> \1 --infra-id <infra_id> \2 --base-domain <basedomain> \3 --sts-creds <path_to_sts_credential_file> \4 --pull-secret <path_to_pull_secret> \5 --region <region> \6 --generate-ssh \ --node-pool-replicas <node_pool_replica_count> \7 --namespace <hosted_cluster_namespace> \8 --role-arn <role_name> \9 --render-into <file_name>.yaml10 - 1

- ホステッドクラスターの名前を指定します (例:

example)。 - 2

- インフラストラクチャー名を指定します。

<hosted_cluster_name>と<infra_id>には同じ値を指定する必要があります。そうしないと、multicluster engine for Kubernetes Operator のコンソールに、クラスターが正しく表示されない可能性があります。 - 3

- ベースドメインを指定します (例:

example.com)。 - 4

- AWS STS 認証情報ファイルへのパスを指定します (例:

/home/user/sts-creds/sts-creds.json)。 - 5

- プルシークレットへのパスを指定します (例:

/user/name/pullsecret)。 - 6

- AWS リージョン名を指定します (例:

us-east-1)。 - 7

- ノードプールのレプリカ数を指定します (例:

3)。 - 8

- デフォルトでは、

HostedClusterとNodePoolのすべてのカスタムリソースがclustersnamespace に作成されます。--namespace <namespace>パラメーターを使用すると、特定の namespace にHostedClusterおよびNodePoolカスタムリソースを作成できます。 - 9

- Amazon Resource Name (ARN) を指定します (例:

arn:aws:iam::820196288204:role/myrole)。 - 10

- EC2 インスタンスを共有テナントハードウェア上で実行するか、シングルテナントハードウェア上で実行するかを指定する場合は、このフィールドを含めます。

--render-intoフラグを含めると、Kubernetes リソースが、このフィールドで指定した YAML ファイルにレンダリングされます。この場合、次のステップに進み、YAML ファイルを編集します。

前のコマンドに

--render-intoフラグを含めた場合は、指定した YAML ファイルを編集します。YAML ファイルのNodePool仕様を編集して、EC2 インスタンスを共有ハードウェア上で実行するか、シングルテナントハードウェア上で実行するかを指定します。次に例を示します。サンプル YAML ファイル

apiVersion: hypershift.openshift.io/v1beta1 kind: NodePool metadata: name: <nodepool_name>1 spec: platform: aws: placement: tenancy: "default"2

検証

ホステッドクラスターのステータスを確認し、

AVAILABLEの値がTrueであることを確認します。以下のコマンドを実行します。$ oc get hostedclusters -n <hosted_cluster_namespace>次のコマンドを実行して、ノードプールのリストを取得します。

$ oc get nodepools --namespace <hosted_cluster_namespace>

4.1.8.1. AWS 上のホステッドクラスターへのアクセス

リソースから kubeconfig ファイルと kubeadmin 認証情報を直接取得することで、ホステッドクラスターにアクセスできます。

ホステッドクラスターのアクセスシークレットを理解している必要があります。ホステッドクラスター namespace にはホステッドクラスターリソースが含まれており、Hosted Control Plane namespace では Hosted Control Plane が実行されます。シークレット名の形式は次のとおりです。

-

kubeconfigシークレット:<hosted-cluster-namespace>-<name>-admin-kubeconfig.たとえば、clusters-hypershift-demo-admin-kubeconfigです。 -

kubeadminパスワードシークレット:<hosted-cluster-namespace>-<name>-kubeadmin-password。たとえば、clusters-hypershift-demo-kubeadmin-passwordです。

手順

kubeconfigシークレットには Base64 でエンコードされたkubeconfigフィールドが含まれており、これをデコードしてファイルに保存し、次のコマンドで使用できます。$ oc --kubeconfig <hosted_cluster_name>.kubeconfig get nodeskubeadminパスワードシークレットも Base64 でエンコードされます。これをデコードし、そのパスワードを使用して、ホステッドクラスターの API サーバーまたはコンソールにログインできます。

4.1.8.2. kubeadmin 認証情報を使用して AWS 上のホステッドクラスターにアクセスする

Amazon Web Services (AWS) にホステッドクラスターを作成した後、kubeconfig ファイル、アクセスシークレット、および kubeadmin 認証情報を取得して、ホステッドクラスターにアクセスできます。

ホステッドクラスターのリソースとアクセスシークレットは、ホステッドクラスターの namespace に格納されます。Hosted Control Plane は、Hosted Control Plane の namespace で実行されます。

シークレット名の形式は次のとおりです。

-

kubeconfigシークレット:<hosted_cluster_namespace>-<name>-admin-kubeconfig。たとえば、clusters-hypershift-demo-admin-kubeconfigです。 -

kubeadminパスワードシークレット:<hosted_cluster_namespace>-<name>-kubeadmin-password。たとえば、clusters-hypershift-demo-kubeadmin-passwordです。

kubeadmin パスワードシークレットは、Base64 でエンコードされています。kubeconfig シークレットには、Base64 でエンコードされた kubeconfig 設定が含まれています。Base64 でエンコードされた kubeconfig 設定をデコードし、<hosted_cluster_name>.kubeconfig ファイルに保存する必要があります。

手順

デコードされた

kubeconfig設定を含む<hosted_cluster_name>.kubeconfigファイルを使用して、ホステッドクラスターにアクセスします。以下のコマンドを入力します。$ oc --kubeconfig <hosted_cluster_name>.kubeconfig get nodesAPI サーバーまたはホステッドクラスターのコンソールにログインするには、

kubeadminパスワードシークレットをデコードする必要があります。

4.1.8.3. hcp CLI を使用して AWS 上のホステッドクラスターにアクセスする

hcp コマンドラインインターフェイス (CLI) を使用して、ホステッドクラスターにアクセスできます。

手順

次のコマンドを入力して、