ネットワークの設定および管理

ネットワークインターフェイスおよび高度なネットワーク機能の管理

概要

- ボンディング、VLAN、ブリッジ、トンネル、およびその他のネットワークタイプを設定して、ホストをネットワークに接続できます。

- IPSec と WireGuard は、ホストとネットワーク間にセキュアな VPN を提供します。

- RHEL は、ポリシーベースのルーティングや Multipath TCP (MPTCP) などの高度なネットワーク機能もサポートします。

Red Hat ドキュメントへのフィードバック (英語のみ)

Red Hat ドキュメントに関するご意見やご感想をお寄せください。また、改善点があればお知らせください。

Jira からのフィードバック送信 (アカウントが必要)

- Jira の Web サイトにログインします。

- 上部のナビゲーションバーで Create をクリックします。

- Summary フィールドにわかりやすいタイトルを入力します。

- Description フィールドに、ドキュメントの改善に関するご意見を記入してください。ドキュメントの該当部分へのリンクも追加してください。

- ダイアログの下部にある Create をクリックします。

第1章 一貫したネットワークインターフェイス命名の実装

udev デバイスマネージャーは、Red Hat Enterprise Linux で一貫したデバイス命名を実装します。デバイスマネージャーは、さまざまな命名スキームをサポートしています。デフォルトでは、ファームウェア、トポロジー、および場所の情報に基づいて固定名を割り当てます。

一貫したデバイス命名を使用しない場合、Linux カーネルは固定の接頭辞とインデックスを組み合わせて名前をネットワークインターフェイスに割り当てます。カーネルがネットワークデバイスを初期化すると、インデックスが増加します。たとえば、eth0 は、起動時にプローブされる最初のイーサネットデバイスを表します。別のネットワークインターフェイスコントローラーをシステムに追加すると、再起動後にデバイスが異なる順序で初期化される可能性があるため、カーネルデバイス名の割り当てが一定でなくなります。その場合、カーネルはデバイスに別の名前を付けることがあります。

この問題を解決するために、udev は一貫したデバイス名を割り当てます。これには、次の利点があります。

- 再起動してもデバイス名が変わりません。

- ハードウェアを追加または削除しても、デバイス名が固定されたままになります。

- 不具合のあるハードウェアをシームレスに交換できます。

- ネットワークの命名はステートレスであり、明示的な設定ファイルは必要ありません。

通常、Red Hat は、一貫したデバイス命名が無効になっているシステムはサポートしていません。例外は、Red Hat ナレッジベースのソリューション記事 Is it safe to set net.ifnames=0 を参照してください。

1.1. udev デバイスマネージャーによるネットワークインターフェイスの名前変更の仕組み

udev デバイスマネージャーは、ネットワークインターフェイスに一貫した命名スキームを適用するために、一連のルールを処理します。

ルールファイルの順序:

オプション:

/usr/lib/udev/rules.d/60-net.rulesこのファイルは、

initscripts-rename-deviceパッケージをインストールした場合にのみ存在します。/usr/lib/udev/rules.d/60-net.rulesファイルは、非推奨の/usr/lib/udev/rename_deviceヘルパーユーティリティーが/etc/sysconfig/network-scripts/ifcfg-*ファイルのHWADDRパラメーターを検索することを定義します。変数に設定した値がインターフェイスの MAC アドレスに一致すると、ヘルパーユーティリティーは、インターフェイスの名前を、ifcfgファイルのDEVICEパラメーターに設定した名前に変更します。システムがキーファイル形式の NetworkManager 接続プロファイルのみを使用する場合、

udevはこの手順をスキップします。Dell システムのみ:

/usr/lib/udev/rules.d/71-biosdevname.rulesこのファイルは、

biosdevnameパッケージがインストールされている場合にのみ存在します。このルールファイルは、前の手順でインターフェイスの名前が変更されていない場合に、biosdevnameユーティリティーが命名ポリシーに従ってインターフェイスの名前を変更することを定義します。注記biosdevnameは Dell システムにのみインストールして使用してください。/usr/lib/udev/rules.d/75-net-description.rulesこのファイルは、

udevがネットワークインターフェイスを検査し、udevの内部変数にプロパティーを設定する方法を定義します。これらの変数は、次のステップで/usr/lib/udev/rules.d/80-net-setup-link.rulesファイルによって処理されます。一部のプロパティーは未定義である場合があります。/usr/lib/udev/rules.d/80-net-setup-link.rulesこのファイルは

udevサービスのnet_setup_linkビルトインを呼び出します。udevは/usr/lib/systemd/network/99-default.linkファイルのNamePolicyパラメーターのポリシーの順序に基づいてインターフェイスの名前を変更します。詳細は、ネットワークインターフェイスの命名ポリシー を参照してください。どのポリシーも適用されない場合、

udevはインターフェイスの名前を変更しません。

1.2. ネットワークインターフェイスの命名ポリシー

デフォルトでは、udev デバイスマネージャーは /usr/lib/systemd/network/99-default.link ファイルを使用して、インターフェイスの名前を変更する方法を決定します。このファイルの NamePolicy パラメーターは、udev がどの命名ポリシーをどの順序で適用するかを定義します。

デフォルトの順序:

NamePolicy=keep kernel database onboard slot path

次の表では、NamePolicy パラメーターで指定された最初に一致するポリシーに基づく、udev のさまざまなアクションを説明します。

| ポリシー | 説明 | 名前の例 |

|---|---|---|

| keep |

デバイスにユーザー空間で割り当てられた名前がすでにある場合、 | |

| kernel |

デバイス名が予測可能であるとカーネルが通知した場合、 |

|

| database |

このポリシーは、 |

|

| onboard | デバイス名には、ファームウェアまたは BIOS が提供するオンボードデバイスのインデックス番号が含まれます。 |

|

| slot | デバイス名には、ファームウェアまたは BIOS が提供する PCI Express (PCIe) ホットプラグのスロットインデックス番号が含まれます。 |

|

| path | デバイス名には、ハードウェアのコネクターの物理的な場所が含まれます。 |

|

| mac | デバイス名には MAC アドレスが含まれます。デフォルトでは、Red Hat Enterprise Linux はこのポリシーを使用しませんが、管理者はこのポリシーを有効にすることができます。 |

|

1.3. ネットワークインターフェイスの命名スキーム

udev デバイスマネージャーは、デバイスドライバーが提供する一定のインターフェイス属性を使用して、一貫したデバイス名を生成します。

新しいバージョンの udev によってサービスが特定のインターフェイス名を作成する方法が変更された場合、Red Hat は、新しいスキームバージョンを追加し、システム上の systemd.net-naming-scheme(7) man ページに詳細を記載します。デフォルトでは、Red Hat Enterprise Linux (RHEL) 9 は、ユーザーが RHEL のそれ以降のマイナーバージョンをインストールまたは更新した場合でも、rhel-9.0 命名スキームを使用します。

新しいドライバーによってネットワークインターフェイスの属性がさらに増加するのを防ぐために、rhel-net-naming-sysattrs パッケージで /usr/lib/udev/hwdb.d/50-net-naming-sysattr-allowlist.hwdb データベースが提供されています。このデータベースは、udev サービスがネットワークインターフェイス名を作成するのに使用できる sysfs 値を定義します。このデータベース内のエントリーは、バージョン管理され、スキームバージョンの影響を受けます。

RHEL 9.4 以降では、すべての rhel-8.* 命名スキームも使用できます。

デフォルト以外のスキームを使用する場合は、ネットワークインターフェイスの命名スキームを切り替える ことができます。

さまざまなデバイスタイプおよびプラットフォームの命名スキームの詳細は、システム上の systemd.net-naming-scheme(7) man ページを参照してください。

1.4. 別のネットワークインターフェイス命名スキームへの切り替え

デフォルトでは、(RHEL) は、RHEL の新しいマイナーバージョンをインストールまたは更新した場合でも 、rhel-9.0 命名スキームを使用します。デフォルトの命名スキームはほとんどの状況に適していますが、別のスキームバージョンに切り替える必要がある場合もあります。

命名スキームを変更する必要がある場合の例:

- 新しいスキームによりインターフェイス名にスロット番号などの追加属性を追加すると、デバイスをより適切に識別できるようになります。

-

新しいスキームにより、カーネルによって割り当てられたデバイス名 (

eth*) にudevがフォールバックするのを防ぐことができます。これは、ドライバーが 2 つ以上のインターフェイスに対して一意の名前を生成するのに十分な一意の属性を提供していない場合に発生します。

前提条件

- サーバーのコンソールにアクセスできる。

手順

ネットワークインターフェイスをリスト表示します。

# ip link show 2: eno1: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...インターフェイスの MAC アドレスを記録します。

オプション: ネットワークインターフェイスの

ID_NET_NAMING_SCHEMEプロパティーを表示して、RHEL が現在使用している命名スキームを特定します。# udevadm info --query=property --property=ID_NET_NAMING_SCHEME /sys/class/net/eno1 ID_NET_NAMING_SCHEME=rhel-9.0このプロパティーは

loループバックデバイスでは使用できないことに注意してください。インストールされているすべてのカーネルのコマンドラインに

net.naming-scheme=<scheme>オプションを追加します。次に例を示します。# grubby --update-kernel=ALL --args=net.naming-scheme=rhel-9.4システムを再起動します。

# reboot記録した MAC アドレスに基づいて、命名スキームの変更により変更されたネットワークインターフェイスの新しい名前を特定します。

# ip link show 2: eno1np0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...スキームを切り替えた後、

udevによって、指定された MAC アドレスを持つデバイスにeno1np0という名前が付けられます。これは以前はeno1という名前でした。以前の名前を持つインターフェイスを使用する NetworkManager 接続プロファイルを特定します。

# nmcli -f device,name connection show DEVICE NAME eno1 example_profile ...接続プロファイルの

connection.interface-nameプロパティーを新しいインターフェイス名に設定します。# nmcli connection modify example_profile connection.interface-name "eno1np0"接続プロファイルを再アクティブ化します。

# nmcli connection up example_profile

検証

ネットワークインターフェイスの

ID_NET_NAMING_SCHEMEプロパティーを表示して、RHEL が現在使用している命名スキームを特定します。# udevadm info --query=property --property=ID_NET_NAMING_SCHEME /sys/class/net/eno1np0 ID_NET_NAMING_SCHEME=_rhel-9.4

1.5. インストール時のイーサネットインターフェイスの接頭辞のカスタマイズ

イーサネットインターフェイスにデフォルトのデバイス命名ポリシーを使用しない場合は、Red Hat Enterprise Linux (RHEL) のインストール時にカスタムデバイス接頭辞を設定できます。

Red Hat は、RHEL のインストール時に接頭辞を設定した場合にのみ、カスタマイズされたイーサネット接頭辞を持つシステムをサポートします。すでにデプロイされているシステムでの prefixdevname ユーティリティーの使用はサポートされていません。

インストール時にデバイス接頭辞を設定した場合、udev サービスはインストール後にイーサネットインターフェイスに <prefix><index> という形式を使用します。たとえば、接頭辞 net を設定すると、サービスはイーサネットインターフェイスに net0、net1 などの名前を割り当てます。

udev サービスはカスタム接頭辞にインデックスを追加し、既知のイーサネットインターフェイスのインデックス値を保存します。インターフェイスを追加すると、udev は、以前に割り当てたインデックス値より 1 大きいインデックス値を新しいインターフェイスに割り当てます。

前提条件

- 接頭辞が ASCII 文字で構成されている。

- 接頭辞が英数字の文字列である。

- 接頭辞が 16 文字未満である。

-

接頭辞が、

eth、eno、ens、emなどの他の既知のネットワークインターフェイス接頭辞と競合しない。

手順

- Red Hat Enterprise Linux インストールメディアを起動します。

ブートマネージャーで、次の手順を実行します。

-

Install Red Hat Enterprise Linux <version>エントリーを選択します。 - Tab を押してエントリーを編集します。

-

net.ifnames.prefix=<prefix>をカーネルオプションに追加します。 - Enter を押してインストールプログラムを起動します。

-

- Red Hat Enterprise Linux をインストールします。

検証

インターフェイス名を確認するには、ネットワークインターフェイスを表示します。

# ip link show ... 2: net0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...

1.6. udev ルールを使用したユーザー定義のネットワークインターフェイス名の設定

udev ルールを使用して、組織の要件を反映したカスタムネットワークインターフェイス名を実装できます。

手順

名前を変更するネットワークインターフェイスを特定します。

# ip link show ... enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...インターフェイスの MAC アドレスを記録します。

インターフェイスのデバイスタイプ ID を表示します。

# cat /sys/class/net/enp1s0/type 1/etc/udev/rules.d/70-persistent-net.rulesファイルを作成し、名前を変更する各インターフェイスのルールを追加します。SUBSYSTEM=="net",ACTION=="add",ATTR{address}=="<MAC_address>",ATTR{type}=="<device_type_id>",NAME="<new_interface_name>"重要ブートプロセス中に一貫したデバイス名が必要な場合は、ファイル名として

70-persistent-net.rulesのみを使用してください。RAM ディスクイメージを再生成すると、dracutユーティリティーはこの名前のファイルをinitrdイメージに追加します。たとえば、次のルールを使用して、MAC アドレス

00:00:5e:00:53:1aのインターフェイスの名前をprovider0に変更します。SUBSYSTEM=="net",ACTION=="add",ATTR{address}=="00:00:5e:00:53:1a",ATTR{type}=="1",NAME="provider0"オプション:

initrdRAM ディスクイメージを再生成します。# dracut -fこの手順は、RAM ディスクにネットワーク機能が必要な場合にのみ必要です。たとえば、ルートファイルシステムが iSCSI などのネットワークデバイスに保存されている場合がこれに当てはまります。

名前を変更するインターフェイスを使用する NetworkManager 接続プロファイルを特定します。

# nmcli -f device,name connection show DEVICE NAME enp1s0 example_profile ...接続プロファイルの

connection.interface-nameプロパティーの設定を解除します。# nmcli connection modify example_profile connection.interface-name ""一時的に、新しいインターフェイス名と以前のインターフェイス名の両方に一致するように接続プロファイルを設定します。

# nmcli connection modify example_profile match.interface-name "provider0 enp1s0"システムを再起動します。

# rebootリンクファイルで指定した MAC アドレスを持つデバイスの名前が

provider0に変更されていることを確認します。# ip link show provider0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc mq state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...新しいインターフェイス名のみと一致するように接続プロファイルを設定します。

# nmcli connection modify example_profile match.interface-name "provider0"これで、接続プロファイルから古いインターフェイス名が削除されました。

接続プロファイルを再アクティブ化します。

# nmcli connection up example_profile

1.7. systemd リンクファイルを使用したユーザー定義のネットワークインターフェイス名の設定

systemd リンクファイルを使用して、組織の要件を反映したカスタムネットワークインターフェイス名を実装できます。

前提条件

- NetworkManager がこのインターフェイスを管理していない。または、対応する接続プロファイルが キーファイル形式 を使用している。

手順

名前を変更するネットワークインターフェイスを特定します。

# ip link show ... enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...インターフェイスの MAC アドレスを記録します。

/etc/systemd/network/ディレクトリーがない場合は作成します。# mkdir -p /etc/systemd/network/名前を変更するインターフェイスごとに、次の内容を含む

70-*.linkファイルを/etc/systemd/network/ディレクトリーに作成します。[Match] MACAddress=<MAC_address> [Link] Name=<new_interface_name>重要udevのルールベースのソリューションとファイル名の一貫性を保つために、接頭辞70-を付けたファイル名を使用してください。たとえば、MAC アドレス

00:00:5e:00:53:1aのインターフェイスの名前をprovider0に変更するには、次の内容を含む/etc/systemd/network/70-provider0.linkファイルを作成します。[Match] MACAddress=00:00:5e:00:53:1a [Link] Name=provider0オプション:

initrdRAM ディスクイメージを再生成します。# dracut -fこの手順は、RAM ディスクにネットワーク機能が必要な場合にのみ必要です。たとえば、ルートファイルシステムが iSCSI などのネットワークデバイスに保存されている場合がこれに当てはまります。

名前を変更するインターフェイスを使用する NetworkManager 接続プロファイルを特定します。

# nmcli -f device,name connection show DEVICE NAME enp1s0 example_profile ...接続プロファイルの

connection.interface-nameプロパティーの設定を解除します。# nmcli connection modify example_profile connection.interface-name ""一時的に、新しいインターフェイス名と以前のインターフェイス名の両方に一致するように接続プロファイルを設定します。

# nmcli connection modify example_profile match.interface-name "provider0 enp1s0"システムを再起動します。

# rebootリンクファイルで指定した MAC アドレスを持つデバイスの名前が

provider0に変更されていることを確認します。# ip link show provider0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc mq state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...新しいインターフェイス名のみと一致するように接続プロファイルを設定します。

# nmcli connection modify example_profile match.interface-name "provider0"これで、接続プロファイルから古いインターフェイス名が削除されました。

接続プロファイルを再度アクティベートします。

# nmcli connection up example_profile

1.8. systemd リンクファイルを使用したネットワークインターフェイスへの代替名の割り当て

代替インターフェイス名の命名を使用すると、カーネルはネットワークインターフェイスに追加の名前を割り当てることができます。この代替名は、ネットワークインターフェイス名を必要とするコマンドで通常のインターフェイス名と同じように使用できます。

前提条件

- 代替名に ASCII 文字が使用されている。

- 代替名が 128 文字未満である。

手順

ネットワークインターフェイス名とその MAC アドレスを表示します。

# ip link show ... enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP mode DEFAULT group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff ...代替名を割り当てるインターフェイスの MAC アドレスを記録します。

/etc/systemd/network/ディレクトリーがない場合は作成します。# mkdir -p /etc/systemd/network/代替名が必要なインターフェイスごとに、

/etc/systemd/network/ディレクトリーに、一意の名前と.link接尾辞を持つ/usr/lib/systemd/network/99-default.linkファイルのコピーを作成します。次に例を示します。# cp /usr/lib/systemd/network/99-default.link /etc/systemd/network/98-lan.link前のステップで作成したファイルを変更します。

[Match]セクションを次のように書き換え、AlternativeNameエントリーを[Link]セクションに追加します。[Match] MACAddress=<MAC_address> [Link] ... AlternativeName=<alternative_interface_name_1> AlternativeName=<alternative_interface_name_2> AlternativeName=<alternative_interface_name_n>たとえば、次の内容を含む

/etc/systemd/network/70-altname.linkファイルを作成して、MAC アドレス00:00:5e:00:53:1aのインターフェイスに代替名としてproviderを割り当てます。[Match] MACAddress=00:00:5e:00:53:1a [Link] NamePolicy=keep kernel database onboard slot path AlternativeNamesPolicy=database onboard slot path MACAddressPolicy=none AlternativeName=providerinitrdRAM ディスクイメージを再生成します。# dracut -fシステムを再起動します。

# reboot

検証

代替インターフェイス名を使用します。たとえば、代替名

providerを使用してデバイスの IP アドレス設定を表示します。# ip address show provider 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 00:00:5e:00:53:1a brd ff:ff:ff:ff:ff:ff altname provider ...

第2章 イーサネット接続の設定

NetworkManager は、ホストにインストールされている各イーサネットアダプターの接続プロファイルを作成します。デフォルトでは、このプロファイルは IPv4 接続と IPv6 接続の両方に DHCP を使用します。

次の場合は、この自動作成されたプロファイルを変更するか、新しいプロファイルを追加してください。

- ネットワークに、静的 IP アドレス設定などのカスタム設定が必要な場合

- ホストが異なるネットワーク間をローミングするため、複数のプロファイルが必要な場合

Red Hat Enterprise Linux は、イーサネット接続を設定するためのさまざまなオプションを管理者に提供します。以下に例を示します。

-

nmcliを使用して、コマンドラインで接続を設定します。 -

nmtuiを使用して、テキストベースのユーザーインターフェイスで接続を設定します。 -

GNOME Settings メニューまたは

nm-connection-editorアプリケーションを使用して、グラフィカルインターフェイスで接続を設定します。 - nmstatectl を使用して、Nmstate API を介して接続を設定する。

- RHEL システムロールを使用して、1 つまたは複数のホストで接続の設定を自動化します。

Microsoft Azure クラウドで実行しているホストでイーサネット接続を手動で設定する場合は、cloud-init サービスを無効にするか、クラウド環境から取得したネットワーク設定を無視するように設定します。それ以外の場合は、cloud-init は、手動で設定したネットワーク設定を次回の再起動時に上書きされます。

2.1. nmcli を使用したイーサネット接続の設定

イーサネット経由でホストをネットワークに接続する場合は、nmcli ユーティリティーを使用してコマンドラインで接続の設定を管理できます。

前提条件

- サーバーの構成に物理または仮想イーサネットネットワークインターフェイスコントローラー (NIC) が存在する。

手順

NetworkManager 接続プロファイルをリストします。

# nmcli connection show NAME UUID TYPE DEVICE Wired connection 1 a5eb6490-cc20-3668-81f8-0314a27f3f75 ethernet enp1s0デフォルトでは、NetworkManager はホスト内の各 NIC のプロファイルを作成します。この NIC を特定のネットワークにのみ接続する予定がある場合は、自動作成されたプロファイルを調整してください。この NIC をさまざまな設定のネットワークに接続する予定がある場合は、ネットワークごとに個別のプロファイルを作成してください。

追加の接続プロファイルを作成する場合は、次のように実行します。

# nmcli connection add con-name <connection-name> ifname <device-name> type ethernet既存のプロファイルを変更するには、この手順をスキップしてください。

オプション: 接続プロファイルの名前を変更します。

# nmcli connection modify "Wired connection 1" connection.id "Internal-LAN"ホストに複数のプロファイルがある場合は、わかりやすい名前を付けると、プロファイルの目的を識別しやすくなります。

接続プロファイルの現在の設定を表示します。

# nmcli connection show Internal-LAN ... connection.interface-name: enp1s0 connection.autoconnect: yes ipv4.method: auto ipv6.method: auto ...IPv4 を設定します。

DHCP を使用するには、次のように実行します。

# nmcli connection modify Internal-LAN ipv4.method autoipv4.methodがすでにauto(デフォルト) に設定されている場合は、この手順をスキップしてください。静的 IPv4 アドレス、ネットワークマスク、デフォルトゲートウェイ、DNS サーバー、および検索ドメインを設定するには、次のように実行します。

# nmcli connection modify Internal-LAN ipv4.method manual ipv4.addresses 192.0.2.1/24 ipv4.gateway 192.0.2.254 ipv4.dns 192.0.2.200 ipv4.dns-search example.com

IPv6 設定を行います。

ステートレスアドレス自動設定 (SLAAC) を使用するには、次のように実行します。

# nmcli connection modify Internal-LAN ipv6.method autoipv6.methodがすでにauto(デフォルト) に設定されている場合は、この手順をスキップしてください。静的 IPv6 アドレス、ネットワークマスク、デフォルトゲートウェイ、DNS サーバー、および検索ドメインを設定するには、次のように実行します。

# nmcli connection modify Internal-LAN ipv6.method manual ipv6.addresses 2001:db8:1::fffe/64 ipv6.gateway 2001:db8:1::fffe ipv6.dns 2001:db8:1::ffbb ipv6.dns-search example.com

プロファイルの他の設定をカスタマイズするには、次のコマンドを使用します。

# nmcli connection modify <connection-name> <setting> <value>値はスペースまたはセミコロンで引用符で囲みます。

プロファイルをアクティブ化します。

# nmcli connection up Internal-LAN

検証

NIC の IP 設定を表示します。

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 デフォルトゲートウェイを表示します。

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 デフォルトゲートウェイを表示します。

# ip -6 route show default default via 2001:db8:1::fffe dev enp1s0 proto static metric 102 pref mediumDNS 設定を表示します。

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb複数の接続プロファイルが同時にアクティブな場合、

nameserverエントリーの順序は、これらのプロファイルの DNS 優先度の値と接続タイプによって異なります。pingユーティリティーを使用して、このホストがパケットを他のホストに送信できることを確認します。# ping <host-name-or-IP-address>

トラブルシューティング

- ネットワークケーブルがホストとスイッチに差し込まれていることを確認します。

- リンク障害がこのホストだけに存在するか、同じスイッチに接続された他のホストにも存在するかを確認します。

- ネットワークケーブルとネットワークインターフェイスが予想どおりに機能していることを確認します。ハードウェア診断手順を実行し、不具合のあるケーブルとネットワークインターフェイスカードを交換します。

- ディスクの設定がデバイスの設定と一致しない場合は、NetworkManager を起動するか再起動して、インメモリー接続を作成することで、デバイスの設定を反映します。この問題の詳細と回避方法は、Red Hat ナレッジベースソリューション NetworkManager duplicates a connection after restart of NetworkManager service を参照してください。

2.2. nmcli インタラクティブエディターを使用したイーサネット接続の設定

イーサネット経由でホストをネットワークに接続する場合は、nmcli ユーティリティーを使用してコマンドラインで接続の設定を管理できます。

前提条件

- サーバーの構成に物理または仮想イーサネットネットワークインターフェイスコントローラー (NIC) が存在する。

手順

NetworkManager 接続プロファイルをリストします。

# nmcli connection show NAME UUID TYPE DEVICE Wired connection 1 a5eb6490-cc20-3668-81f8-0314a27f3f75 ethernet enp1s0デフォルトでは、NetworkManager はホスト内の各 NIC のプロファイルを作成します。この NIC を特定のネットワークにのみ接続する予定がある場合は、自動作成されたプロファイルを調整してください。この NIC をさまざまな設定のネットワークに接続する予定がある場合は、ネットワークごとに個別のプロファイルを作成してください。

nmcliインタラクティブモードで起動します。追加の接続プロファイルを作成するには、次のように実行します。

# nmcli connection edit type ethernet con-name "<connection-name>"既存の接続プロファイルを変更するには、次のように実行します。

# nmcli connection edit con-name "<connection-name>"

オプション: 接続プロファイルの名前を変更します。

nmcli> set connection.id Internal-LANホストに複数のプロファイルがある場合は、わかりやすい名前を付けると、プロファイルの目的を識別しやすくなります。

nmcliが引用符を名前の一部としてしまうことを避けるため、スペースを含む ID を設定する場合は引用符を使用しないでください。たとえば、Example Connectionを ID として設定するには、set connection.id Example Connectionと入力します。接続プロファイルの現在の設定を表示します。

nmcli> print ... connection.interface-name: enp1s0 connection.autoconnect: yes ipv4.method: auto ipv6.method: auto ...新しい接続プロファイルを作成する場合は、ネットワークインターフェイスを設定します。

nmcli> set connection.interface-name enp1s0IPv4 を設定します。

DHCP を使用するには、次のように実行します。

nmcli> set ipv4.method autoipv4.methodがすでにauto(デフォルト) に設定されている場合は、この手順をスキップしてください。静的 IPv4 アドレス、ネットワークマスク、デフォルトゲートウェイ、DNS サーバー、および検索ドメインを設定するには、次のように実行します。

nmcli> ipv4.addresses 192.0.2.1/24 Do you also want to set 'ipv4.method' to 'manual'? [yes]: yes nmcli> ipv4.gateway 192.0.2.254 nmcli> ipv4.dns 192.0.2.200 nmcli> ipv4.dns-search example.com

IPv6 設定を行います。

ステートレスアドレス自動設定 (SLAAC) を使用するには、次のように実行します。

nmcli> set ipv6.method autoipv6.methodがすでにauto(デフォルト) に設定されている場合は、この手順をスキップしてください。静的 IPv6 アドレス、ネットワークマスク、デフォルトゲートウェイ、DNS サーバー、および検索ドメインを設定するには、次のように実行します。

nmcli> ipv6.addresses 2001:db8:1::fffe/64 Do you also want to set 'ipv6.method' to 'manual'? [yes]: yes nmcli> ipv6.gateway 2001:db8:1::fffe nmcli> ipv6.dns 2001:db8:1::ffbb nmcli> ipv6.dns-search example.com

接続をアクティベートして保存します。

nmcli> save persistentインタラクティブモードを終了します。

nmcli> quit

検証

NIC の IP 設定を表示します。

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 デフォルトゲートウェイを表示します。

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 デフォルトゲートウェイを表示します。

# ip -6 route show default default via 2001:db8:1::fffe dev enp1s0 proto static metric 102 pref mediumDNS 設定を表示します。

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb複数の接続プロファイルが同時にアクティブな場合、

nameserverエントリーの順序は、これらのプロファイルの DNS 優先度の値と接続タイプによって異なります。pingユーティリティーを使用して、このホストがパケットを他のホストに送信できることを確認します。# ping <host-name-or-IP-address>

トラブルシューティング

- ネットワークケーブルがホストとスイッチに差し込まれていることを確認します。

- リンク障害がこのホストだけに存在するか、同じスイッチに接続された他のホストにも存在するかを確認します。

- ネットワークケーブルとネットワークインターフェイスが予想どおりに機能していることを確認します。ハードウェア診断手順を実行し、不具合のあるケーブルとネットワークインターフェイスカードを交換します。

- ディスクの設定がデバイスの設定と一致しない場合は、NetworkManager を起動するか再起動して、インメモリー接続を作成することで、デバイスの設定を反映します。この問題の詳細と回避方法は、Red Hat ナレッジベースソリューション NetworkManager duplicates a connection after restart of NetworkManager service を参照してください。

2.3. nmtui を使用したイーサネット接続の設定

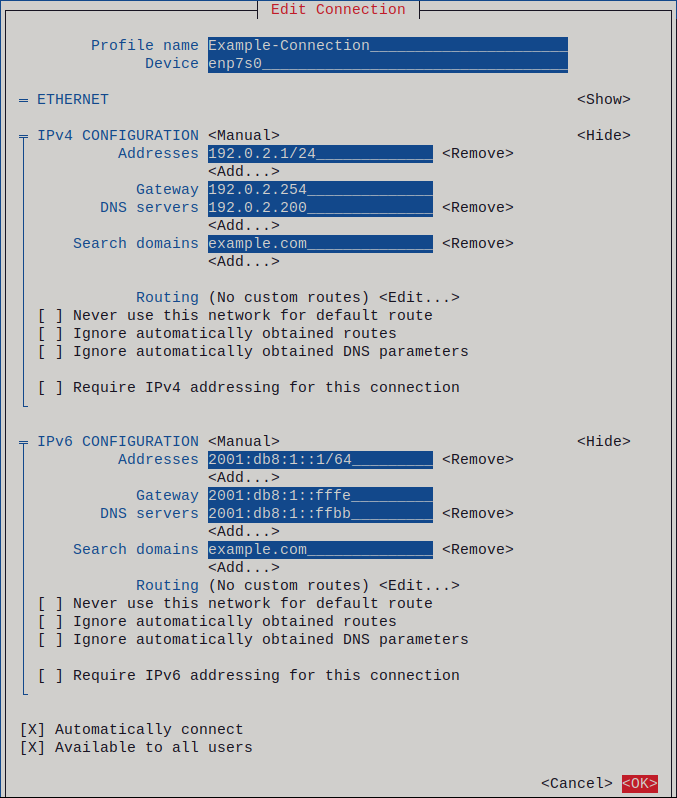

ホストをイーサネットネットワークに接続すると、テキストベースのユーザーインターフェイスで接続の設定を管理できます。グラフィカルインターフェイスのないホスト上で新しいプロファイルを作成し、既存のプロファイルを更新するには、nmtui アプリケーションを使用します。

nmtui で以下を行います。

- カーソルキーを使用してナビゲートします。

- ボタンを選択して Enter を押します。

- Space を使用してチェックボックスをオンまたはオフにします。

- 前の画面に戻るには、ESC を使用します。

前提条件

- サーバーの構成に物理または仮想イーサネットネットワークインターフェイスコントローラー (NIC) が存在する。

手順

接続に使用するネットワークデバイス名がわからない場合は、使用可能なデバイスを表示します。

# nmcli device status DEVICE TYPE STATE CONNECTION enp1s0 ethernet unavailable -- ...nmtuiを開始します。# nmtui- Edit a connection を選択し、Enter を押します。

新しい接続プロファイルを追加するか、既存の接続プロファイルを変更するかを選択します。

新しいプロファイルを作成するには、以下を実行します。

- Add を押します。

- ネットワークタイプのリストから Ethernet を選択し、Enter を押します。

- 既存のプロファイルを変更するには、リストからプロファイルを選択し、Enter を押します。

オプション: 接続プロファイルの名前を更新します。

ホストに複数のプロファイルがある場合は、わかりやすい名前を付けると、プロファイルの目的を識別しやすくなります。

- 新しい接続プロファイルを作成する場合は、ネットワークデバイス名を connection フィールドに入力します。

環境に応じて、

IPv4 configurationおよびIPv6 configuration領域に IP アドレス設定を設定します。これを行うには、これらの領域の横にあるボタンを押して、次を選択します。- この接続に IP アドレスが必要ない場合は、Disabled にします。

- DHCP サーバーが IP アドレスをこの NIC に動的に割り当てる場合は、Automatic にします。

ネットワークで静的 IP アドレス設定が必要な場合は、Manual にします。この場合、さらにフィールドに入力する必要があります。

- 設定するプロトコルの横にある Show を押して、追加のフィールドを表示します。

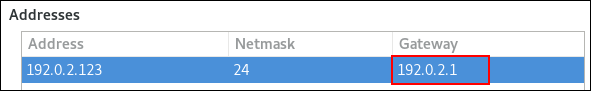

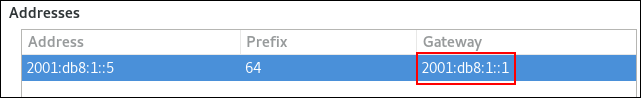

Addresses の横にある Add を押して、IP アドレスとサブネットマスクを Classless Inter-Domain Routing (CIDR) 形式で入力します。

サブネットマスクを指定しない場合、NetworkManager は IPv4 アドレスに

/32サブネットマスクを設定し、IPv6 アドレスに/64サブネットマスクを設定します。- デフォルトゲートウェイのアドレスを入力します。

- DNS servers の横にある Add を押して、DNS サーバーのアドレスを入力します。

- Search domains の横にある Add を押して、DNS 検索ドメインを入力します。

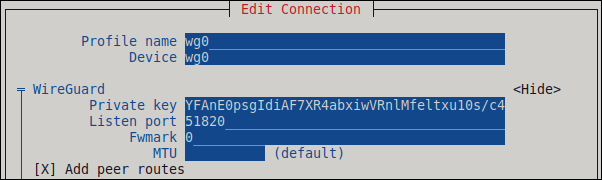

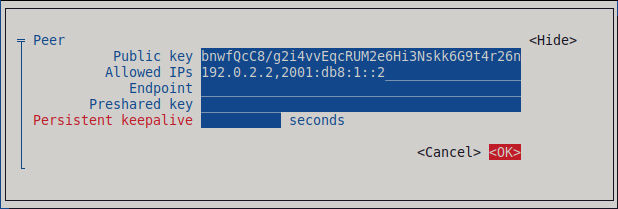

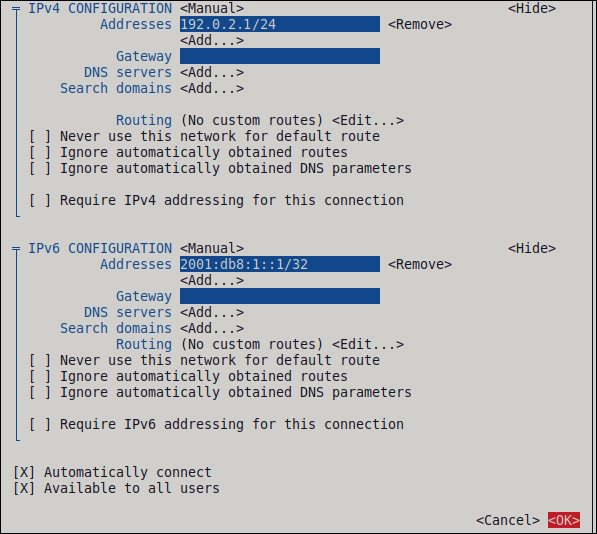

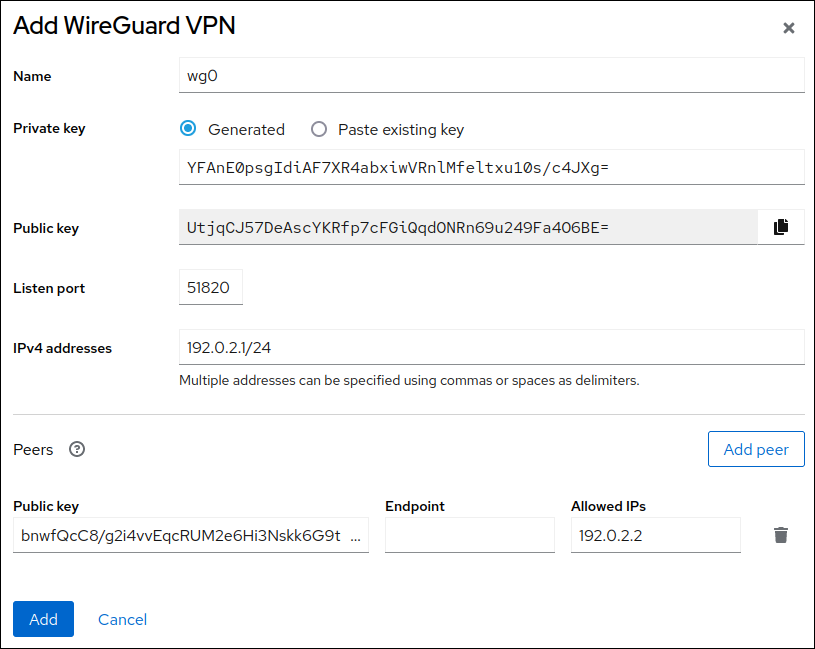

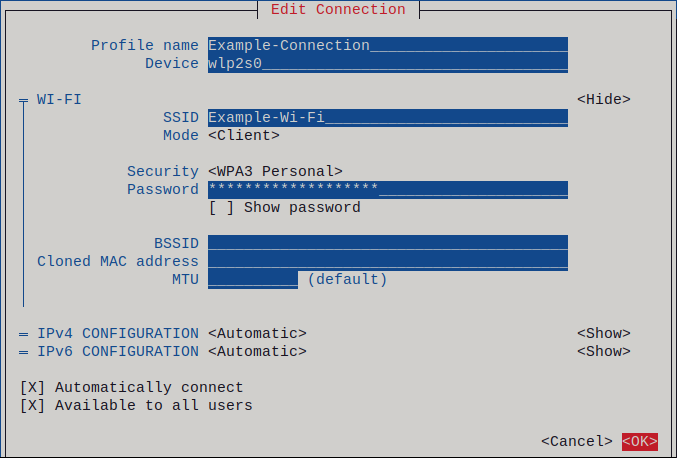

図2.1 静的 IP アドレス設定によるイーサネット接続の例

- OK を押すと、新しい接続が作成され、自動的にアクティブ化されます。

- Back を押してメインメニューに戻ります。

-

Quit を選択し、Enter キーを押して

nmtuiアプリケーションを閉じます。

検証

NIC の IP 設定を表示します。

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 デフォルトゲートウェイを表示します。

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 デフォルトゲートウェイを表示します。

# ip -6 route show default default via 2001:db8:1::fffe dev enp1s0 proto static metric 102 pref mediumDNS 設定を表示します。

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb複数の接続プロファイルが同時にアクティブな場合、

nameserverエントリーの順序は、これらのプロファイルの DNS 優先度の値と接続タイプによって異なります。pingユーティリティーを使用して、このホストがパケットを他のホストに送信できることを確認します。# ping <host-name-or-IP-address>

トラブルシューティング

- ネットワークケーブルがホストとスイッチに差し込まれていることを確認します。

- リンク障害がこのホストだけに存在するか、同じスイッチに接続された他のホストにも存在するかを確認します。

- ネットワークケーブルとネットワークインターフェイスが予想どおりに機能していることを確認します。ハードウェア診断手順を実行し、不具合のあるケーブルとネットワークインターフェイスカードを交換します。

- ディスクの設定がデバイスの設定と一致しない場合は、NetworkManager を起動するか再起動して、インメモリー接続を作成することで、デバイスの設定を反映します。この問題の詳細と回避方法は、Red Hat ナレッジベースソリューション NetworkManager duplicates a connection after restart of NetworkManager service を参照してください。

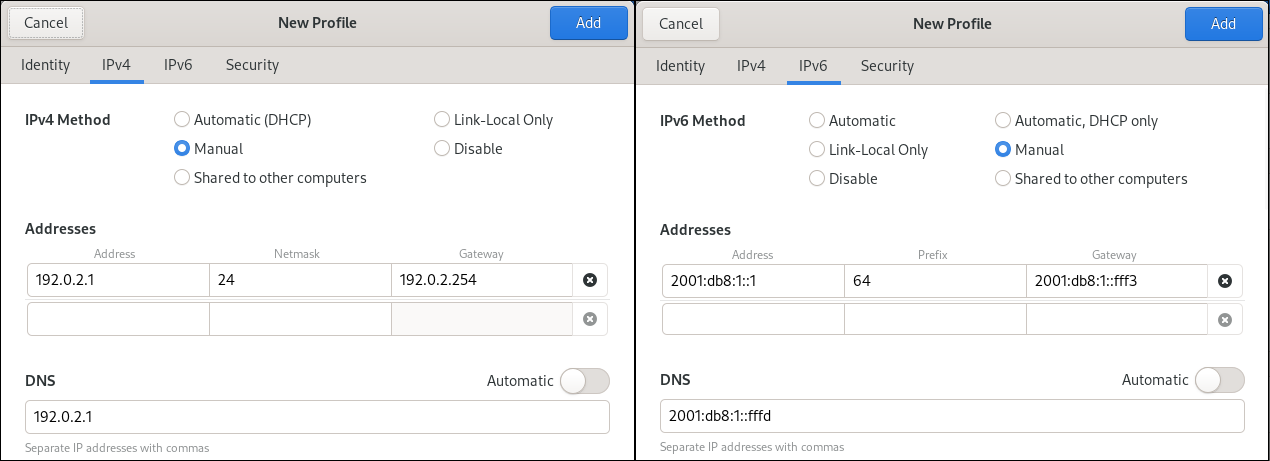

2.4. control-center によるイーサネット接続の設定

イーサネット経由でホストをネットワークに接続する場合は、GNOME 設定メニューを使用して、グラフィカルインターフェイスで接続の設定を管理できます。

control-center は、nm-connection-editor アプリケーションまたは nmcli ユーティリティーほど多くの設定オプションに対応していないことに注意してください。

前提条件

- サーバーの構成に物理または仮想イーサネットネットワークインターフェイスコントローラー (NIC) が存在する。

- GNOME がインストールされている。

手順

-

Super キーを押して

Settingsを入力し、Enter を押します。 - 左側のナビゲーションにある Network を選択します。

新しい接続プロファイルを追加するか、既存の接続プロファイルを変更するかを選択します。

- 新しいプロファイルを作成するには、Ethernet エントリーの横にある ボタンをクリックします。

- 既存のプロファイルを変更するには、プロファイルエントリーの横にある歯車アイコンをクリックします。

オプション: Identity タブで、接続プロファイルの名前を更新します。

ホストに複数のプロファイルがある場合は、わかりやすい名前を付けると、プロファイルの目的を識別しやすくなります。

環境に応じて、IPv4 タブと IPv6 タブで IP アドレス設定を設定します。

-

DHCP または IPv6 ステートレスアドレス自動設定 (SLAAC) を使用するには、方法として

Automatic (DHCP)を選択します (デフォルト)。 静的 IP アドレス、ネットワークマスク、デフォルトゲートウェイ、DNS サーバー、および検索ドメインを設定するには、方法として

Manualを選択し、タブのフィールドに入力します。

-

DHCP または IPv6 ステートレスアドレス自動設定 (SLAAC) を使用するには、方法として

接続プロファイルを追加するか変更するかに応じて、 または ボタンをクリックして接続を保存します。

GNOME の

control-centerは、接続を自動的にアクティブにします。

検証

NIC の IP 設定を表示します。

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 デフォルトゲートウェイを表示します。

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 デフォルトゲートウェイを表示します。

# ip -6 route show default default via 2001:db8:1::fffe dev enp1s0 proto static metric 102 pref mediumDNS 設定を表示します。

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb複数の接続プロファイルが同時にアクティブな場合、

nameserverエントリーの順序は、これらのプロファイルの DNS 優先度の値と接続タイプによって異なります。pingユーティリティーを使用して、このホストがパケットを他のホストに送信できることを確認します。# ping <host-name-or-IP-address>

トラブルシューティングの手順

- ネットワークケーブルがホストとスイッチに差し込まれていることを確認します。

- リンク障害がこのホストだけに存在するか、同じスイッチに接続された他のホストにも存在するかを確認します。

- ネットワークケーブルとネットワークインターフェイスが予想どおりに機能していることを確認します。ハードウェア診断手順を実行し、不具合のあるケーブルとネットワークインターフェイスカードを交換します。

- ディスクの設定がデバイスの設定と一致しない場合は、NetworkManager を起動するか再起動して、インメモリー接続を作成することで、デバイスの設定を反映します。この問題の詳細と回避方法は、Red Hat ナレッジベースソリューション NetworkManager duplicates a connection after restart of NetworkManager service を参照してください。

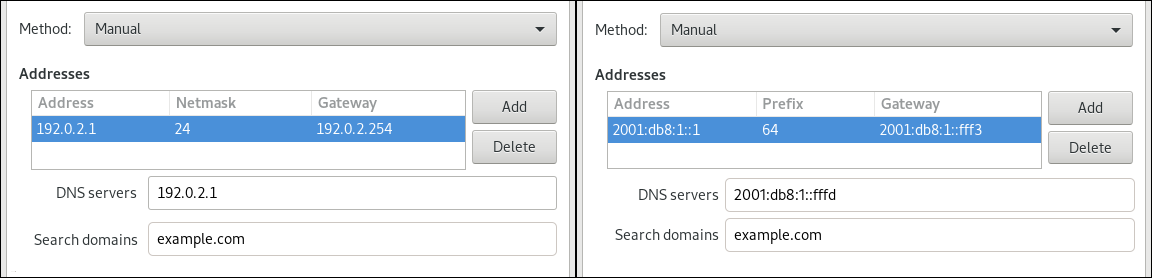

2.5. nm-connection-editor を使用したイーサネット接続の設定

イーサネット経由でホストをネットワークに接続する場合は、nm-connection-editor アプリケーションを使用して、グラフィカルインターフェイスで接続の設定を管理できます。

前提条件

- サーバーの構成に物理または仮想イーサネットネットワークインターフェイスコントローラー (NIC) が存在する。

- GNOME がインストールされている。

手順

ターミナルを開き、次のコマンドを入力します。

$ nm-connection-editor新しい接続プロファイルを追加するか、既存の接続プロファイルを変更するかを選択します。

新しいプロファイルを作成するには、以下を実行します。

- ボタンをクリックします。

- 接続タイプとして Ethernet を選択し、 をクリックします。

- 既存のプロファイルを変更するには、プロファイルエントリーをダブルクリックします。

オプション: Connection フィールドでプロファイルの名前を更新します。

ホストに複数のプロファイルがある場合は、わかりやすい名前を付けると、プロファイルの目的を識別しやすくなります。

新しいプロファイルを作成する場合は、

Ethernetタブでデバイスを選択します。

環境に応じて、IPv4 Settings タブと IPv6 Settings タブで IP アドレス設定を設定します。

-

DHCP または IPv6 ステートレスアドレス自動設定 (SLAAC) を使用するには、方法として

Automatic (DHCP)を選択します (デフォルト)。 静的 IP アドレス、ネットワークマスク、デフォルトゲートウェイ、DNS サーバー、および検索ドメインを設定するには、方法として

Manualを選択し、タブのフィールドに入力します。

-

DHCP または IPv6 ステートレスアドレス自動設定 (SLAAC) を使用するには、方法として

- をクリックします。

- nm-connection-editor を閉じます。

検証

NIC の IP 設定を表示します。

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 デフォルトゲートウェイを表示します。

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 デフォルトゲートウェイを表示します。

# ip -6 route show default default via 2001:db8:1::fffe dev enp1s0 proto static metric 102 pref mediumDNS 設定を表示します。

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb複数の接続プロファイルが同時にアクティブな場合、

nameserverエントリーの順序は、これらのプロファイルの DNS 優先度の値と接続タイプによって異なります。pingユーティリティーを使用して、このホストがパケットを他のホストに送信できることを確認します。# ping <host-name-or-IP-address>

トラブルシューティングの手順

- ネットワークケーブルがホストとスイッチに差し込まれていることを確認します。

- リンク障害がこのホストだけに存在するか、同じスイッチに接続された他のホストにも存在するかを確認します。

- ネットワークケーブルとネットワークインターフェイスが予想どおりに機能していることを確認します。ハードウェア診断手順を実行し、不具合のあるケーブルとネットワークインターフェイスカードを交換します。

- ディスクの設定がデバイスの設定と一致しない場合は、NetworkManager を起動するか再起動して、インメモリー接続を作成することで、デバイスの設定を反映します。この問題の詳細と回避方法は、Red Hat ナレッジベースソリューション NetworkManager duplicates a connection after restart of NetworkManager service を参照してください。

2.6. nmstatectl でインターフェイス名を指定して静的 IP アドレスによるイーサネット接続を設定する

宣言型の Nmstate API を使用すると、静的 IP アドレス、ゲートウェイ、および DNS 設定を使用してイーサネット接続を設定し、それらを指定のインターフェイス名に割り当てることができます。Nmstate を使用すると、結果が必ず設定ファイルと一致したものになります。一致しない場合は、変更がロールバックされます。

前提条件

- サーバーの構成に物理または仮想イーサネットネットワークインターフェイスコントローラー (NIC) が存在する。

-

nmstateパッケージがインストールされている。

手順

以下の内容を含む YAML ファイル (例:

~/create-ethernet-profile.yml) を作成します。--- interfaces: - name: enp1s0 type: ethernet state: up ipv4: enabled: true address: - ip: 192.0.2.1 prefix-length: 24 dhcp: false ipv6: enabled: true address: - ip: 2001:db8:1::1 prefix-length: 64 autoconf: false dhcp: false routes: config: - destination: 0.0.0.0/0 next-hop-address: 192.0.2.254 next-hop-interface: enp1s0 - destination: ::/0 next-hop-address: 2001:db8:1::fffe next-hop-interface: enp1s0 dns-resolver: config: search: - example.com server: - 192.0.2.200 - 2001:db8:1::ffbbこれらの設定では、次の設定を使用して

enp1s0デバイスのイーサネット接続プロファイルを定義します。-

静的 IPv4 アドレス:

192.0.2.1(サブネットマスクが/24) -

静的 IPv6 アドレス:

2001:db8:1::1(サブネットマスクが/64) -

IPv4 デフォルトゲートウェイ -

192.0.2.254 -

IPv6 デフォルトゲートウェイ -

2001:db8:1::fffe -

IPv4 DNS サーバー -

192.0.2.200 -

IPv6 DNS サーバー -

2001:db8:1::ffbb -

DNS 検索ドメイン -

example.com

-

静的 IPv4 アドレス:

オプション:

interfacesプロパティーでidentifier: mac-addressおよびmac-address: <mac_address>プロパティーを定義すると、ネットワークインターフェイスカードを名前ではなく MAC アドレスで識別できます。次に例を示します。--- interfaces: - name: <profile_name> type: ethernet identifier: mac-address mac-address: <mac_address> ...設定をシステムに適用します。

# nmstatectl apply ~/create-ethernet-profile.yml

検証

現在の状態を YAML 形式で表示します。

# nmstatectl show enp1s0NIC の IP 設定を表示します。

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 デフォルトゲートウェイを表示します。

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 デフォルトゲートウェイを表示します。

# ip -6 route show default default via 2001:db8:1::fffe dev enp1s0 proto static metric 102 pref mediumDNS 設定を表示します。

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb複数の接続プロファイルが同時にアクティブな場合、

nameserverエントリーの順序は、これらのプロファイルの DNS 優先度の値と接続タイプによって異なります。pingユーティリティーを使用して、このホストがパケットを他のホストに送信できることを確認します。# ping <host-name-or-IP-address>

2.7. nmstatectl で PCI アドレスを指定して静的 IP アドレスによるイーサネット接続を設定する

宣言型の Nmstate API を使用すると、静的 IP アドレス、ゲートウェイ、および DNS 設定を使用してイーサネット接続を設定し、それらを PCI アドレスに基づいてデバイスに割り当てることができます。Nmstate を使用すると、結果が必ず設定ファイルと一致したものになります。一致しない場合は、変更がロールバックされます。

前提条件

- サーバーの構成に物理イーサネットネットワークインターフェイスコントローラー (NIC) が存在する。

-

デバイスの PCI アドレスがわかっている。PCI アドレスは、

ethtool -i <interface_name> | grep bus-infoコマンドを使用して確認できます。 -

nmstateパッケージがインストールされている。

手順

以下の内容を含む YAML ファイル (例:

~/create-ethernet-profile.yml) を作成します。--- interfaces: - name: <profile_name> type: ethernet state: up identifier: pci-address pci-address: 0000:00:14.3 ipv4: enabled: true address: - ip: 192.0.2.1 prefix-length: 24 dhcp: false ipv6: enabled: true address: - ip: 2001:db8:1::1 prefix-length: 64 autoconf: false dhcp: false routes: config: - destination: 0.0.0.0/0 next-hop-address: 192.0.2.254 next-hop-interface: <profile_name> - destination: ::/0 next-hop-address: 2001:db8:1::fffe next-hop-interface: <profile_name> dns-resolver: config: search: - example.com server: - 192.0.2.200 - 2001:db8:1::ffbb上記の設定により、ID

0000:00:14.3のデバイスのイーサネット接続プロファイルが、以下の設定で定義されます。-

静的 IPv4 アドレス:

192.0.2.1(サブネットマスクが/24) -

静的 IPv6 アドレス:

2001:db8:1::1(サブネットマスクが/64) -

IPv4 デフォルトゲートウェイ -

192.0.2.254 -

IPv6 デフォルトゲートウェイ -

2001:db8:1::fffe -

IPv4 DNS サーバー -

192.0.2.200 -

IPv6 DNS サーバー -

2001:db8:1::ffbb -

DNS 検索ドメイン -

example.com

-

静的 IPv4 アドレス:

設定をシステムに適用します。

# nmstatectl apply ~/create-ethernet-profile.yml

検証

現在の状態を YAML 形式で表示します。

# nmstatectl show <interface_name>NIC の IP 設定を表示します。

# ip address show <interface_name> 2: :<interface_name> <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute <interface_name> valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 デフォルトゲートウェイを表示します。

# ip route show default default via 192.0.2.254 dev <interface_name> proto static metric 102IPv6 デフォルトゲートウェイを表示します。

# ip -6 route show default default via 2001:db8:1::fffe dev <interface_name> proto static metric 102 pref mediumDNS 設定を表示します。

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbbpingユーティリティーを使用して、このホストがパケットを他のホストに送信できることを確認します。# ping <host-name-or-IP-address>

2.8. network RHEL システムロールとインターフェイス名を使用した静的 IP アドレスでのイーサネット接続の設定

network RHEL システムロールを使用すると、静的 IP アドレス、ゲートウェイ、および DNS 設定を使用してイーサネット接続を設定し、それらを指定のインターフェイス名に割り当てることができます。

Red Hat Enterprise Linux ホストをイーサネットネットワークに接続するには、ネットワークデバイスの NetworkManager 接続プロファイルを作成します。Ansible と network RHEL システムロールを使用すると、このプロセスを自動化し、Playbook で定義されたホスト上の接続プロファイルをリモートで設定できます。

通常、管理者は Playbook を再利用します。Ansible が静的 IP アドレスを割り当てるホストごとに、個別の Playbook を管理することはありません。そうすることにより、Playbook 内の変数を使用し、外部ファイルで設定を維持できます。その結果、複数のホストに個別の設定を動的に割り当てるために必要な Playbook が 1 つだけになります。

前提条件

- コントロールノードと管理対象ノードの準備が完了している。

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。 - サーバーの構成に物理または仮想イーサネットデバイスが存在する。

- 管理対象ノードが NetworkManager を使用してネットワークを設定している。

手順

~/inventoryファイルを編集し、ホストエントリーにホスト固有の設定を追加します。managed-node-01.example.com interface=enp1s0 ip_v4=192.0.2.1/24 ip_v6=2001:db8:1::1/64 gateway_v4=192.0.2.254 gateway_v6=2001:db8:1::fffe managed-node-02.example.com interface=enp1s0 ip_v4=192.0.2.2/24 ip_v6=2001:db8:1::2/64 gateway_v4=192.0.2.254 gateway_v6=2001:db8:1::fffe次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - name: Configure the network hosts: managed-node-01.example.com,managed-node-02.example.com tasks: - name: Ethernet connection profile with static IP address settings ansible.builtin.include_role: name: redhat.rhel_system_roles.network vars: network_connections: - name: "{{ interface }}" interface_name: "{{ interface }}" type: ethernet autoconnect: yes ip: address: - "{{ ip_v4 }}" - "{{ ip_v6 }}" gateway4: "{{ gateway_v4 }}" gateway6: "{{ gateway_v6 }}" dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com state: upこの Playbook は、インベントリーファイルから各ホストの特定の値を動的に読み取り、すべてのホストで同じ設定に対して Playbook 内の静的な値を使用します。

Playbook で使用されるすべての変数の詳細は、コントロールノードの

/usr/share/ansible/roles/rhel-system-roles.network/README.mdファイルを参照してください。Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

検証

管理対象ノードの Ansible fact をクエリーし、アクティブなネットワーク設定を確認します。

# ansible managed-node-01.example.com -m ansible.builtin.setup ... "ansible_default_ipv4": { "address": "192.0.2.1", "alias": "enp1s0", "broadcast": "192.0.2.255", "gateway": "192.0.2.254", "interface": "enp1s0", "macaddress": "52:54:00:17:b8:b6", "mtu": 1500, "netmask": "255.255.255.0", "network": "192.0.2.0", "prefix": "24", "type": "ether" }, "ansible_default_ipv6": { "address": "2001:db8:1::1", "gateway": "2001:db8:1::fffe", "interface": "enp1s0", "macaddress": "52:54:00:17:b8:b6", "mtu": 1500, "prefix": "64", "scope": "global", "type": "ether" }, ... "ansible_dns": { "nameservers": [ "192.0.2.1", "2001:db8:1::ffbb" ], "search": [ "example.com" ] }, ...

2.9. network RHEL システムロールとデバイスパスを使用した静的 IP アドレスでのイーサネット接続の設定

network RHEL システムロールを使用すると、静的 IP アドレス、ゲートウェイ、および DNS 設定を使用してイーサネット接続を設定し、それらを名前ではなくパスに基づいてデバイスに割り当てることができます。

Red Hat Enterprise Linux ホストをイーサネットネットワークに接続するには、ネットワークデバイスの NetworkManager 接続プロファイルを作成します。Ansible と network RHEL システムロールを使用すると、このプロセスを自動化し、Playbook で定義されたホスト上の接続プロファイルをリモートで設定できます。

前提条件

- コントロールノードと管理対象ノードの準備が完了している。

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。 - サーバーの構成に物理または仮想イーサネットデバイスが存在する。

- 管理対象ノードが NetworkManager を使用してネットワークを設定している。

-

デバイスのパスがわかっている。

udevadm info /sys/class/net/<device_name> | grep ID_PATH=コマンドを使用すると、デバイスパスを表示できます。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Ethernet connection profile with static IP address settings ansible.builtin.include_role: name: redhat.rhel_system_roles.network vars: network_connections: - name: example match: path: - pci-0000:00:0[1-3].0 - '&!pci-0000:00:02.0' type: ethernet autoconnect: yes ip: address: - 192.0.2.1/24 - 2001:db8:1::1/64 gateway4: 192.0.2.254 gateway6: 2001:db8:1::fffe dns: - 192.0.2.200 - 2001:db8:1::ffbb dns_search: - example.com state: upサンプル Playbook で指定されている設定は次のとおりです。

match-

設定を適用するために満たす必要がある条件を定義します。この変数は

pathオプションでのみ使用できます。 path-

デバイスの永続パスを定義します。固定パスまたは式の形式で設定できます。値には修飾子とワイルドカードを含めることができます。この例では、PCI ID

0000:00:0[1-3].0に一致するデバイスには設定を適用しますが、0000:00:02.0に一致するデバイスには適用しません。

Playbook で使用されるすべての変数の詳細は、コントロールノードの

/usr/share/ansible/roles/rhel-system-roles.network/README.mdファイルを参照してください。Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

検証

管理対象ノードの Ansible fact をクエリーし、アクティブなネットワーク設定を確認します。

# ansible managed-node-01.example.com -m ansible.builtin.setup ... "ansible_default_ipv4": { "address": "192.0.2.1", "alias": "enp1s0", "broadcast": "192.0.2.255", "gateway": "192.0.2.254", "interface": "enp1s0", "macaddress": "52:54:00:17:b8:b6", "mtu": 1500, "netmask": "255.255.255.0", "network": "192.0.2.0", "prefix": "24", "type": "ether" }, "ansible_default_ipv6": { "address": "2001:db8:1::1", "gateway": "2001:db8:1::fffe", "interface": "enp1s0", "macaddress": "52:54:00:17:b8:b6", "mtu": 1500, "prefix": "64", "scope": "global", "type": "ether" }, ... "ansible_dns": { "nameservers": [ "192.0.2.1", "2001:db8:1::ffbb" ], "search": [ "example.com" ] }, ...

2.10. nmstatectl でインターフェイス名を指定して動的 IP アドレスによる Ethernet 接続を設定する

宣言型の Nmstate API を使用すると、静的 IP アドレス、ゲートウェイ、および DNS 設定を使用してイーサネット接続を設定し、PCI アドレスに基づいてデバイスに設定を割り当てることができます。Nmstate を使用すると、結果が必ず設定ファイルと一致したものになります。一致しない場合は、変更がロールバックされます。

前提条件

- サーバーの構成に物理または仮想イーサネットネットワークインターフェイスコントローラー (NIC) が存在する。

- DHCP サーバーをネットワークで使用できる。

-

nmstateパッケージがインストールされている。

手順

以下の内容を含む YAML ファイル (例:

~/create-ethernet-profile.yml) を作成します。--- interfaces: - name: enp1s0 type: ethernet state: up ipv4: enabled: true auto-dns: true auto-gateway: true auto-routes: true dhcp: true ipv6: enabled: true auto-dns: true auto-gateway: true auto-routes: true autoconf: true dhcp: trueこれらの設定では、

enp1s0デバイスのイーサネット接続プロファイルを定義します。接続では、DHCP サーバーと IPv6 ステートレスアドレス自動設定 (SLAAC) から、IPv4 アドレス、IPv6 アドレス、デフォルトゲートウェイ、ルート、DNS サーバー、および検索ドメインを取得します。オプション:

interfacesプロパティーでidentifier: mac-addressおよびmac-address: <mac_address>プロパティーを定義すると、ネットワークインターフェイスカードを名前ではなく MAC アドレスで識別できます。次に例を示します。--- interfaces: - name: <profile_name> type: ethernet identifier: mac-address mac-address: <mac_address> ...設定をシステムに適用します。

# nmstatectl apply ~/create-ethernet-profile.yml

検証

現在の状態を YAML 形式で表示します。

# nmstatectl show enp1s0NIC の IP 設定を表示します。

# ip address show enp1s0 2: enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0 valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 デフォルトゲートウェイを表示します。

# ip route show default default via 192.0.2.254 dev enp1s0 proto static metric 102IPv6 デフォルトゲートウェイを表示します。

# ip -6 route show default default via 2001:db8:1::fffe dev enp1s0 proto static metric 102 pref mediumDNS 設定を表示します。

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbb複数の接続プロファイルが同時にアクティブな場合、

nameserverエントリーの順序は、これらのプロファイルの DNS 優先度の値と接続タイプによって異なります。pingユーティリティーを使用して、このホストがパケットを他のホストに送信できることを確認します。# ping <host-name-or-IP-address>

2.11. nmstatectl で PCI アドレスを指定して動的 IP アドレスによるイーサネット接続を設定する

宣言型 Nmstate API を使用すると、DHCP および IPv6 ステートレスアドレス自動設定 (SLAAC) を使用してイーサネット接続を設定し、PCI アドレスに基づいてデバイスに設定を割り当てることができます。Nmstate を使用すると、結果が必ず設定ファイルと一致したものになります。一致しない場合は、変更がロールバックされます。

前提条件

- サーバーの構成に物理イーサネットデバイスが存在する。

- ネットワーク内で DHCP サーバーと SLAAC が利用できる。

- 管理対象ホストは、NetworkManager を使用してネットワークを設定します。

-

デバイスの PCI アドレスがわかっている。PCI アドレスは、

ethtool -i <interface_name> | grep bus-infoコマンドを使用して確認できます。 -

nmstateパッケージがインストールされている。

手順

以下の内容を含む YAML ファイル (例:

~/create-ethernet-profile.yml) を作成します。--- interfaces: - name: <profile_name> type: ethernet state: up identifier: pci-address pci-address: 0000:00:14.3 ipv4: enabled: true auto-dns: true auto-gateway: true auto-routes: true dhcp: true ipv6: enabled: true auto-dns: true auto-gateway: true auto-routes: true autoconf: true dhcp: true上記の設定により、ID

0000:00:14.3のデバイスのイーサネット接続プロファイルが定義されます。接続では、DHCP サーバーと IPv6 ステートレスアドレス自動設定 (SLAAC) から、IPv4 アドレス、IPv6 アドレス、デフォルトゲートウェイ、ルート、DNS サーバー、および検索ドメインを取得します。設定をシステムに適用します。

# nmstatectl apply ~/create-ethernet-profile.yml

検証

現在の状態を YAML 形式で表示します。

# nmstatectl show <interface_name>NIC の IP 設定を表示します。

# ip address show <interface_name> 2: <interface_name>: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc fq_codel state UP group default qlen 1000 link/ether 52:54:00:17:b8:b6 brd ff:ff:ff:ff:ff:ff inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute <interface_name> valid_lft forever preferred_lft forever inet6 2001:db8:1::fffe/64 scope global noprefixroute valid_lft forever preferred_lft foreverIPv4 デフォルトゲートウェイを表示します。

# ip route show default default via 192.0.2.254 dev <interface_name> proto static metric 102IPv6 デフォルトゲートウェイを表示します。

# ip -6 route show default default via 2001:db8:1::fffe dev <interface_name> proto static metric 102 pref mediumDNS 設定を表示します。

# cat /etc/resolv.conf search example.com nameserver 192.0.2.200 nameserver 2001:db8:1::ffbbpingユーティリティーを使用して、このホストがパケットを他のホストに送信できることを確認します。# ping <host-name-or-IP-address>

2.12. network RHEL システムロールとインターフェイス名を使用した動的 IP アドレスでのイーサネット接続の設定

network RHEL システムロールを使用すると、DHCP サーバーおよび IPv6 ステートレスアドレス自動設定 (SLAAC) から IP アドレス、ゲートウェイ、および DNS 設定を取得するイーサネット接続を設定できます。このロールを使用すると、指定のインターフェイス名に接続プロファイルを割り当てることができます。

Red Hat Enterprise Linux ホストをイーサネットネットワークに接続するには、ネットワークデバイスの NetworkManager 接続プロファイルを作成します。Ansible と network RHEL システムロールを使用すると、このプロセスを自動化し、Playbook で定義されたホスト上の接続プロファイルをリモートで設定できます。

前提条件

- コントロールノードと管理対象ノードの準備が完了している。

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。 - サーバーの構成に物理または仮想イーサネットデバイスが存在する。

- ネットワーク内で DHCP サーバーと SLAAC が利用できる。

- 管理対象ノードが NetworkManager サービスを使用してネットワークを設定している。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Ethernet connection profile with dynamic IP address settings ansible.builtin.include_role: name: redhat.rhel_system_roles.network vars: network_connections: - name: enp1s0 interface_name: enp1s0 type: ethernet autoconnect: yes ip: dhcp4: yes auto6: yes state: upサンプル Playbook で指定されている設定は次のとおりです。

dhcp4: yes- DHCP、PPP、または同様のサービスからの自動 IPv4 アドレス割り当てを有効にします。

auto6: yes-

IPv6 自動設定を有効にします。デフォルトでは、NetworkManager はルーター広告を使用します。ルーターが

managedフラグを通知すると、NetworkManager は DHCPv6 サーバーに IPv6 アドレスと接頭辞を要求します。

Playbook で使用されるすべての変数の詳細は、コントロールノードの

/usr/share/ansible/roles/rhel-system-roles.network/README.mdファイルを参照してください。Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

検証

管理対象ノードの Ansible fact をクエリーし、インターフェイスが IP アドレスと DNS 設定を受信したことを確認します。

# ansible managed-node-01.example.com -m ansible.builtin.setup ... "ansible_default_ipv4": { "address": "192.0.2.1", "alias": "enp1s0", "broadcast": "192.0.2.255", "gateway": "192.0.2.254", "interface": "enp1s0", "macaddress": "52:54:00:17:b8:b6", "mtu": 1500, "netmask": "255.255.255.0", "network": "192.0.2.0", "prefix": "24", "type": "ether" }, "ansible_default_ipv6": { "address": "2001:db8:1::1", "gateway": "2001:db8:1::fffe", "interface": "enp1s0", "macaddress": "52:54:00:17:b8:b6", "mtu": 1500, "prefix": "64", "scope": "global", "type": "ether" }, ... "ansible_dns": { "nameservers": [ "192.0.2.1", "2001:db8:1::ffbb" ], "search": [ "example.com" ] }, ...

2.13. network RHEL システムロールとデバイスパスを使用した動的 IP アドレスでのイーサネット接続の設定

network RHEL システムロールを使用すると、DHCP サーバーおよび IPv6 ステートレスアドレス自動設定 (SLAAC) から IP アドレス、ゲートウェイ、および DNS 設定を取得するイーサネット接続を設定できます。このロールにより、デバイスのパスに応じてプロファイルを割り当てることができます。

Red Hat Enterprise Linux ホストをイーサネットネットワークに接続するには、ネットワークデバイスの NetworkManager 接続プロファイルを作成します。Ansible と network RHEL システムロールを使用すると、このプロセスを自動化し、Playbook で定義されたホスト上の接続プロファイルをリモートで設定できます。

前提条件

- コントロールノードと管理対象ノードの準備が完了している。

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。 - サーバーの構成に物理または仮想イーサネットデバイスが存在する。

- ネットワーク内で DHCP サーバーと SLAAC が利用できる。

- 管理対象ホストは、NetworkManager を使用してネットワークを設定します。

-

デバイスのパスがわかっている。

udevadm info /sys/class/net/<device_name> | grep ID_PATH=コマンドを使用すると、デバイスパスを表示できます。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - name: Configure the network hosts: managed-node-01.example.com tasks: - name: Ethernet connection profile with dynamic IP address settings ansible.builtin.include_role: name: redhat.rhel_system_roles.network vars: network_connections: - name: example match: path: - pci-0000:00:0[1-3].0 - '&!pci-0000:00:02.0' type: ethernet autoconnect: yes ip: dhcp4: yes auto6: yes state: upサンプル Playbook で指定されている設定は次のとおりです。

match: path-

設定を適用するために満たす必要がある条件を定義します。この変数は

pathオプションでのみ使用できます。 path: <path_and_expressions>-

デバイスの永続パスを定義します。固定パスまたは式の形式で設定できます。値には修飾子とワイルドカードを含めることができます。この例では、PCI ID

0000:00:0[1-3].0に一致するデバイスには設定を適用しますが、0000:00:02.0に一致するデバイスには適用しません。 dhcp4: yes- DHCP、PPP、または同様のサービスからの自動 IPv4 アドレス割り当てを有効にします。

auto6: yes-

IPv6 自動設定を有効にします。デフォルトでは、NetworkManager はルーター広告を使用します。ルーターが

managedフラグを通知すると、NetworkManager は DHCPv6 サーバーに IPv6 アドレスと接頭辞を要求します。

Playbook で使用されるすべての変数の詳細は、コントロールノードの

/usr/share/ansible/roles/rhel-system-roles.network/README.mdファイルを参照してください。Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

検証

管理対象ノードの Ansible fact をクエリーし、インターフェイスが IP アドレスと DNS 設定を受信したことを確認します。

# ansible managed-node-01.example.com -m ansible.builtin.setup ... "ansible_default_ipv4": { "address": "192.0.2.1", "alias": "enp1s0", "broadcast": "192.0.2.255", "gateway": "192.0.2.254", "interface": "enp1s0", "macaddress": "52:54:00:17:b8:b6", "mtu": 1500, "netmask": "255.255.255.0", "network": "192.0.2.0", "prefix": "24", "type": "ether" }, "ansible_default_ipv6": { "address": "2001:db8:1::1", "gateway": "2001:db8:1::fffe", "interface": "enp1s0", "macaddress": "52:54:00:17:b8:b6", "mtu": 1500, "prefix": "64", "scope": "global", "type": "ether" }, ... "ansible_dns": { "nameservers": [ "192.0.2.1", "2001:db8:1::ffbb" ], "search": [ "example.com" ] }, ...

2.14. インターフェイス名による単一の接続プロファイルを使用した複数のイーサネットインターフェイスの設定

NetworkManager は、接続プロファイル内でインターフェイス名にワイルドカードを使用することをサポートしています。これにより、複数のイーサネットインターフェース用のプロファイルを 1 つにまとめることができます。これは、動的な IP アドレス割り当てを使用するイーサネットネットワーク間をホストが移動する場合に便利です。

前提条件

- サーバーの構成に物理または仮想イーサネットデバイスが複数存在する。

- DHCP サーバーをネットワークで使用できる。

- ホストに接続プロファイルが存在しません。

手順

enpで始まるすべてのインターフェイス名に適用される接続プロファイルを追加します。# nmcli connection add con-name "Wired connection 1" connection.multi-connect multiple match.interface-name enp* type ethernet

検証

単一接続プロファイルのすべての設定を表示します。

# nmcli connection show "Wired connection 1" connection.id: Wired connection 1 ... connection.multi-connect: 3 (multiple) match.interface-name: enp* ...3は、インターフェイスが特定の瞬間に複数回アクティブになる可能性があることを示します。接続プロファイルは、match.interface-nameパラメーターのパターンに一致するすべてのデバイスを使用するため、接続プロファイルには同じ Universally Unique Identifier (UUID) があります。接続のステータスを表示します。

# nmcli connection show NAME UUID TYPE DEVICE ... Wired connection 1 6f22402e-c0cc-49cf-b702-eaf0cd5ea7d1 ethernet enp7s0 Wired connection 1 6f22402e-c0cc-49cf-b702-eaf0cd5ea7d1 ethernet enp8s0 Wired connection 1 6f22402e-c0cc-49cf-b702-eaf0cd5ea7d1 ethernet enp9s0

第4章 NIC チームの設定

ネットワークインターフェイスコントローラー (NIC) チーミングは、物理ネットワークインターフェイスと仮想ネットワークインターフェイスを結合または集約して、より高いスループットまたは冗長性を備えた論理インターフェイスを提供する方法です。NIC チーミングでは、小さなカーネルモジュールを使用して、パケットフローの高速処理と他のタスク用のユーザー空間サービスを実装します。このように、NIC チーミングは、負荷分散と冗長性の要件に応じて簡単に拡張できるスケーラブルなソリューションです。

Red Hat Enterprise Linux は、チームデバイスを設定するためのさまざまなオプションを管理者に提供します。以下に例を示します。

-

nmcliを使用し、コマンドラインを使用してチーム接続を設定します。 - RHEL Web コンソールを使用し、Web ブラウザーを使用してチーム接続を設定します。

-

nm-connection-editorアプリケーションを使用して、グラフィカルインターフェイスでチーム接続を設定します。

NIC チーミングは Red Hat Enterprise Linux 9 では非推奨です。代わりに、ネットワークボンディングドライバーの使用を検討してください。詳細は、ネットワークボンディングの設定 を参照してください。

4.1. ネットワークボンディングへの NIC チーム設定の移行

ネットワークインターフェイスコントローラー (NIC) チーミングは、Red Hat Enterprise Linux 9 では非推奨です。以前の RHEL バージョンからアップグレードした場合など、すでに機能する NIC チームが設定されている場合は、NetworkManager によって管理されるネットワークボンディングに設定を移行できます。

team2bond ユーティリティーは、チーム設定をボンディングに変換するだけです。その後、IP アドレスや DNS 設定など、ボンディングの詳細設定を手動で行う必要があります。

前提条件

-

team-team0NetworkManager の接続プロファイルが設定され、team0デバイスを管理している。 -

teamdパッケージがインストールされている。

手順

オプション:

team-team0NetworkManager 接続の IP 設定を表示します。# nmcli connection show team-team0 | grep -E "^ip" ... ipv4.method: manual ipv4.dns: 192.0.2.253 ipv4.dns-search: example.com ipv4.addresses: 192.0.2.1/24 ipv4.gateway: 192.0.2.254 ... ipv6.method: manual ipv6.dns: 2001:db8:1::fffd ipv6.dns-search: example.com ipv6.addresses: 2001:db8:1::1/64 ipv6.gateway: 2001:db8:1::fffe ...team0デバイスの設定を JSON ファイルにエクスポートします。# teamdctl team0 config dump actual > /tmp/team0.jsonNIC チームを削除します。たとえば、NetworkManager でチームを設定した場合は、

team-team0接続プロファイルと、関連するポートのプロファイルを削除します。# nmcli connection delete team-team0 # nmcli connection delete team-team0-port1 # nmcli connection delete team-team0-port2team2bondユーティリティーをドライランモードで実行して、チームデバイスと同様の設定でネットワークボンディングを設定するnmcliコマンドを表示します。# team2bond --config=/tmp/team0.json --rename=bond0 nmcli con add type bond ifname bond0 bond.options "mode=active-backup,num_grat_arp=1,num_unsol_na=1,resend_igmp=1,miimon=100,miimon=100" nmcli con add type ethernet ifname enp7s0 controller bond0 nmcli con add type ethernet ifname enp8s0 controller bond0最初のコマンドには 2 つの

miimonオプションが含まれます。これは、チーム設定ファイルに 2 つのlink_watchエントリーが含まれていたためです。これはボンディングの作成には影響しないことに注意してください。サービスをチームのデバイス名にバインドし、これらのサービスの更新や破損を回避する場合は、

--rename=bond0を省略します。この場合、team2bondは、チームと同じインターフェイス名をボンディングに使用します。-

team2bondユーティリティーが推奨するボンディングのオプションが正しいことを確認します。 ボンディングを作成します。推奨される

nmcliコマンドを実行するか、--exec-cmdオプションを指定してteam2bondコマンドを再実行できます。# team2bond --config=/tmp/team0.json --rename=bond0 --exec-cmd Connection 'bond-bond0' (0241a531-0c72-4202-80df-73eadfc126b5) successfully added. Connection 'bond-port-enp7s0' (38489729-b624-4606-a784-1ccf01e2f6d6) successfully added. Connection 'bond-port-enp8s0' (de97ec06-7daa-4298-9a71-9d4c7909daa1) successfully added.次の手順では、ボンディング接続プロファイル (

bond-bond0) の名前が必要です。team-team0で以前設定した IPv4 設定を、bond-bond0接続に設定します。# nmcli connection modify bond-bond0 ipv4.addresses '192.0.2.1/24' # nmcli connection modify bond-bond0 ipv4.gateway '192.0.2.254' # nmcli connection modify bond-bond0 ipv4.dns '192.0.2.253' # nmcli connection modify bond-bond0 ipv4.dns-search 'example.com' # nmcli connection modify bond-bond0 ipv4.method manualteam-team0で以前設定した IPv6 設定を、bond-bond0接続に設定します。# nmcli connection modify bond-bond0 ipv6.addresses '2001:db8:1::1/64' # nmcli connection modify bond-bond0 ipv6.gateway '2001:db8:1::fffe' # nmcli connection modify bond-bond0 ipv6.dns '2001:db8:1::fffd' # nmcli connection modify bond-bond0 ipv6.dns-search 'example.com' # nmcli connection modify bond-bond0 ipv6.method manual接続をアクティベートします。

# nmcli connection up bond-bond0

検証

bond-bond0NetworkManager 接続の IP 設定を表示します。# nmcli connection show bond-bond0 | grep -E "^ip" ... ipv4.method: manual ipv4.dns: 192.0.2.253 ipv4.dns-search: example.com ipv4.addresses: 192.0.2.1/24 ipv4.gateway: 192.0.2.254 ... ipv6.method: manual ipv6.dns: 2001:db8:1::fffd ipv6.dns-search: example.com ipv6.addresses: 2001:db8:1::1/64 ipv6.gateway: 2001:db8:1::fffe ...ボンドのステータスを表示します。

# cat /proc/net/bonding/bond0 Ethernet Channel Bonding Driver: v5.13.0-0.rc7.51.el9.x86_64 Bonding Mode: fault-tolerance (active-backup) Primary Slave: None Currently Active Slave: enp7s0 MII Status: up MII Polling Interval (ms): 100 Up Delay (ms): 0 Down Delay (ms): 0 Peer Notification Delay (ms): 0 Slave Interface: enp7s0 MII Status: up Speed: Unknown Duplex: Unknown Link Failure Count: 0 Permanent HW addr: 52:54:00:bf:b1:a9 Slave queue ID: 0 Slave Interface: enp8s0 MII Status: up Speed: Unknown Duplex: Unknown Link Failure Count: 0 Permanent HW addr: 52:54:00:04:36:0f Slave queue ID: 0この例では、両方のポートが起動しています。

ボンディングフェイルオーバーが機能することを確認するには、以下を行います。

- ホストからネットワークケーブルを一時的に削除します。コマンドラインでリンク障害イベントを適切にテストする方法がないことに注意してください。

ボンドのステータスを表示します。

# cat /proc/net/bonding/bond0

4.2. コントローラーおよびポートインターフェイスのデフォルト動作の理解

ボンディングポートインターフェイスを管理する際の NetworkManager のデフォルト動作を理解すると、問題をより効果的にトラブルシューティングできるようになります。

デフォルトの動作:

- コントローラーインターフェイスを起動しても、ポートインターフェイスは自動的に起動しない。

- ポートインターフェイスを起動すると、コントローラーインターフェイスは毎回、起動する。

- コントローラーインターフェイスを停止すると、ポートインターフェイスも停止する。

- ポートのないコントローラーは、静的 IP 接続を開始できる。

- コントローラーにポートがない場合は、DHCP 接続の開始時にポートを待つ。

- DHCP 接続でポートを待機中のコントローラーは、キャリアを伴うポートの追加時に完了する。

- DHCP 接続でポートを待機中のコントローラーは、キャリアを伴わないポートを追加する時に待機を継続する。

4.3. teamd サービス、ランナー、およびリンク監視の理解

チームサービス teamd は、チームドライバーのインスタンスを制御します。このドライバーのインスタンスは、ハードウェアデバイスドライバーのインスタンスを追加して、ネットワークインターフェイスのチームを形成します。チームドライバーは、ネットワークインターフェイス (team0 など) をカーネルに提示します。

teamd サービスは、チーミングのすべてのメソッドに共通のロジックを実装します。この関数は、ラウンドロビンなどの異なる負荷分散とバックアップメソッドに一意で、ランナー と呼ばれる別のコードのユニットにより実装されます。管理者は、JSON (JavaScript Object Notation) 形式でランナーを指定します。インスタンスの作成時に、JSON コードが teamd のインスタンスにコンパイルされます。または、NetworkManager を使用する場合は、team.runner パラメーターにランナーを設定でき、対応する JSON コードを NetworkManager が自動的に作成します。

以下のランナーが利用できます。

-

broadcast- すべてのポートでデータを送信します。 -

roundrobin- 次に、すべてのポートでデータを送信します。 -

activebackup- 1 つのポートにデータを送信します。もう 1 つのポートはバックアップとして維持されます。 -

loadbalance- アクティブな Tx 負荷分散と Berkeley Packet Filter (BPF) ベースの Tx ポートセレクターを持つすべてのポートでデータを送信します。 -

random- 無作為に選択されたポートでデータを送信します。 -

lacp- 802.3ad リンクアグリゲーション制御プロトコル (LACP) を実装します。

teamd サービスはリンク監視を使用して、下位デバイスの状態を監視します。さらに、以下のリンク監視が利用可能です。

-

ethtool-libteamライブラリーは、ethtoolユーティリティーを使用してリンク状態の変更を監視します。これはデフォルトのリンク監視です。 -

arp_ping-libteamライブラリーは、arp_pingユーティリティーでアドレス解決プロトコル (ARP) を使用して、遠端のハードウェアアドレスの存在を監視します。 -

nsna_ping- IPv6 接続では、libteamライブラリーが IPv6 neighbor Discovery プロトコルの Neighbor Advertisement 機能と Neighbor Solicitation 機能を使用して、近くのインターフェイスの存在を監視します。

各ランナーは、lacp を除くリンク監視を使用できます。このランナーは、ethtool リンク監視のみを使用できます。

4.4. nmcli を使用した NIC チームの設定

コマンドラインでネットワークインターフェイスコントローラー (NIC) チームを設定するには、nmcli ユーティリティーを使用します。

NIC チーミングは Red Hat Enterprise Linux 9 では非推奨です。代わりに、ネットワークボンディングドライバーの使用を検討してください。詳細は、ネットワークボンディングの設定 を参照してください。

前提条件

-

teamdおよびNetworkManager-teamパッケージがインストールされている。 - サーバーに、2 つ以上の物理ネットワークデバイスまたは仮想ネットワークデバイスがインストールされている。

- チームのポートとしてイーサネットデバイスを使用するには、物理または仮想のイーサネットデバイスがサーバーにインストールされ、スイッチに接続されている必要があります。

チームのポートにボンディング、ブリッジ、または VLAN デバイスを使用するには、チームの作成時にこれらのデバイスを作成するか、次の説明に従って事前にデバイスを作成することができます。

手順

チームインターフェイスを作成します。

# nmcli connection add type team con-name team0 ifname team0 team.runner activebackupこのコマンドは、

activebackupランナーを使用するteam0という名前の NIC チームを作成します。オプション: リンクウォッチャーを設定します。たとえば、

team0接続プロファイルでethtoolリンク監視を設定するには、次のコマンドを実行します。# nmcli connection modify team0 team.link-watchers "name=ethtool"リンク監視は、さまざまなパラメーターに対応します。リンク監視にパラメーターを設定するには、

nameプロパティーでスペースで区切って指定します。name プロパティーは引用符で囲む必要があることに注意してください。たとえば、ethtoolリンク監視を使用し、delay-upパラメーターを2500ミリ秒 (2.5 秒) で設定するには、次のコマンドを実行します。# nmcli connection modify team0 team.link-watchers "name=ethtool delay-up=2500"複数のリンク監視および各リンク監視を、特定のパラメーターで設定するには、リンク監視をコンマで区切る必要があります。以下の例では、

delay-upパラメーターでethtoolリンク監視を設定します。arp_pingリンク監視は、source-hostパラメーターおよびtarget-hostパラメーターで設定します。# nmcli connection modify team0 team.link-watchers "name=ethtool delay-up=2, name=arp_ping source-host=192.0.2.1 target-host=192.0.2.2"ネットワークインターフェイスを表示し、次のステップでチームに追加するインターフェイスの名前を書き留めておきます。

# nmcli device status DEVICE TYPE STATE CONNECTION enp7s0 ethernet disconnected -- enp8s0 ethernet disconnected -- bond0 bond connected bond0 bond1 bond connected bond1 ...この例では、以下のように設定されています。

-

enp7s0およびenp8s0は設定されません。これらのデバイスをポートとして使用するには、次のステップに接続プロファイルを追加します。いずれの接続にも割り当てられていないチームのイーサネットインターフェイスのみを使用できる点に注意してください。 -

bond0およびbond1には既存の接続プロファイルがあります。これらのデバイスをポートとして使用するには、次の手順でプロファイルを変更します。

-

ポートインターフェイスをチームに割り当てます。

チームに割り当てるインターフェイスが設定されていない場合は、それらの接続プロファイルを新たに作成します。

# nmcli connection add type ethernet port-type team con-name team0-port1 ifname enp7s0 controller team0 # nmcli connection add type ethernet port--type team con-name team0-port2 ifname enp8s0 controller team0これらのコマンドは、

enp7s0およびenp8s0にプロファイルを作成し、team0接続に追加します。既存の接続プロファイルをチームに割り当てるには、以下を実行します。

これらの接続の

controllerパラメーターをteam0に設定します。# nmcli connection modify bond0 controller team0 # nmcli connection modify bond1 controller team0これらのコマンドは、

bond0およびbond1という名前の既存の接続プロファイルをteam0接続に割り当てます。接続を再度アクティブにします。

# nmcli connection up bond0 # nmcli connection up bond1

IPv4 を設定します。

静的 IPv4 アドレス、ネットワークマスク、デフォルトゲートウェイ、および DNS サーバーを

team0接続に設定するには、次のように実行します。# nmcli connection modify team0 ipv4.addresses '192.0.2.1/24' ipv4.gateway '192.0.2.254' ipv4.dns '192.0.2.253' ipv4.dns-search 'example.com' ipv4.method manual- DHCP を使用するために必要な操作はありません。

- この VLAN デバイスを他のデバイスのポートとして使用する予定の場合は、何もする必要はありません。

IPv6 設定を行います。

静的 IPv6 アドレス、ネットワークマスク、デフォルトゲートウェイ、および DNS サーバーを

team0接続に設定するには、次のように実行します。# nmcli connection modify team0 ipv6.addresses '2001:db8:1::1/64' ipv6.gateway '2001:db8:1::fffe' ipv6.dns '2001:db8:1::fffd' ipv6.dns-search 'example.com' ipv6.method manual- この VLAN デバイスを他のデバイスのポートとして使用する予定の場合は、何もする必要はありません。

- ステートレスアドレス自動設定 (SLAAC) を使用する場合、アクションは必要ありません。

接続をアクティベートします。

# nmcli connection up team0

検証

チームのステータスを表示します。

# teamdctl team0 state setup: runner: activebackup ports: enp7s0 link watches: link summary: up instance[link_watch_0]: name: ethtool link: up down count: 0 enp8s0 link watches: link summary: up instance[link_watch_0]: name: ethtool link: up down count: 0 runner: active port: enp7s0この例では、両方のポートが起動しています。

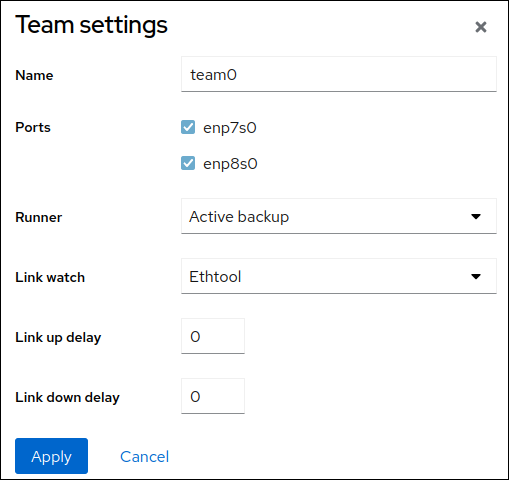

4.5. RHEL Web コンソールを使用した NIC チームの設定

Web ブラウザーベースのインターフェイスを使用してネットワーク設定を管理する場合は、RHEL Web コンソールを使用してネットワークインターフェイスコントローラー (NIC) チームを設定します。

NIC チーミングは Red Hat Enterprise Linux 9 では非推奨です。代わりに、ネットワークボンディングドライバーの使用を検討してください。詳細は、ネットワークボンディングの設定 を参照してください。

前提条件

-

teamdおよびNetworkManager-teamパッケージがインストールされている。 - サーバーに、2 つ以上の物理ネットワークデバイスまたは仮想ネットワークデバイスがインストールされている。

- チームのポートとしてイーサネットデバイスを使用するには、物理または仮想のイーサネットデバイスがサーバーにインストールされ、スイッチに接続されている必要があります。

ボンド、ブリッジ、または VLAN デバイスをチームのポートとして使用するには、次の説明に従って事前に作成します。

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

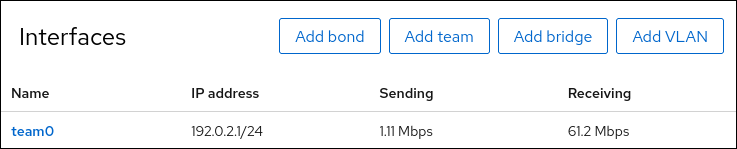

-

画面左側のナビゲーションで

Networkingタブを選択します。 -

Interfacesセクションで をクリックします。 - 作成するチームデバイスの名前を入力します。

- チームのポートにするインターフェイスを選択します。

チームのランナーを選択します。

Load balancingまたは802.3ad LACPを選択すると、Web コンソールに追加のフィールドBalancerが表示されます。リンクウォッチャーを設定します。

-

Ethtoolを選択した場合は、さらに、リンクアップおよびリンクダウンの遅延を設定します。 -

ARP pingまたはNSNA pingを選択し、さらに ping の間隔と ping ターゲットを設定します。

-

- をクリックします。

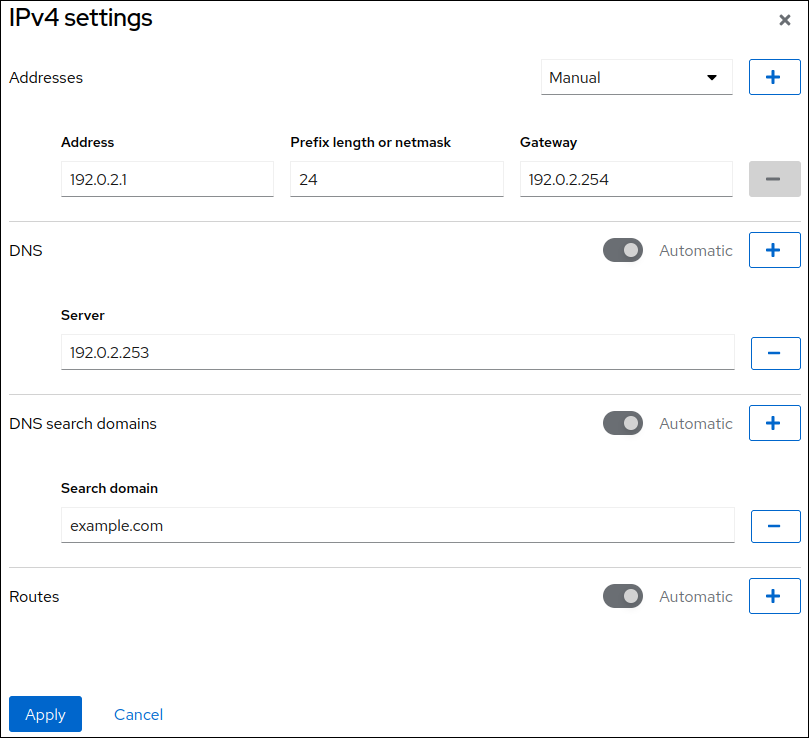

デフォルトでは、チームは動的 IP アドレスを使用します。静的 IP アドレスを設定する場合:

-

Interfacesセクションでチームの名前をクリックします。 -

設定するプロトコルの横にある

Editをクリックします。 -

Addressesの横にあるManualを選択し、IP アドレス、接頭辞、およびデフォルトゲートウェイを入力します。 -

DNSセクションで ボタンをクリックし、DNS サーバーの IP アドレスを入力します。複数の DNS サーバーを設定するには、この手順を繰り返します。 -

DNS search domainsセクションで、 ボタンをクリックし、検索ドメインを入力します。 インターフェイスにスタティックルートが必要な場合は、

Routesセクションで設定します。

- をクリックします。

-

検証

画面左側のナビゲーションで

Networkingタブを選択し、インターフェイスに着信および発信トラフィックがあるかどうかを確認します。

チームのステータスを表示します。

# teamdctl team0 state setup: runner: activebackup ports: enp7s0 link watches: link summary: up instance[link_watch_0]: name: ethtool link: up down count: 0 enp8s0 link watches: link summary: up instance[link_watch_0]: name: ethtool link: up down count: 0 runner: active port: enp7s0この例では、両方のポートが起動しています。

4.6. nm-connection-editor を使用した NIC チームを設定

グラフィカルインターフェイスを備えた Red Hat Enterprise Linux を使用している場合は、nm-connection-editor アプリケーションを使用してネットワークインターフェイスコントローラー (NIC) チームを設定できます。

nm-connection-editor は、新しいポートだけをチームに追加できることに注意してください。既存の接続プロファイルをポートとして使用するには、nmcli を使用した NIC チームの設定 の説明に従って、nmcli ユーティリティーを使用してチームを作成します。

NIC チーミングは Red Hat Enterprise Linux 9 では非推奨です。代わりに、ネットワークボンディングドライバーの使用を検討してください。詳細は、ネットワークボンディングの設定 を参照してください。

前提条件

-

teamdおよびNetworkManager-teamパッケージがインストールされている。 - サーバーに、2 つ以上の物理ネットワークデバイスまたは仮想ネットワークデバイスがインストールされている。

- 物理または仮想のイーサネットデバイスをサーバーにインストールし、チームのポートとしてイーサネットデバイスを使用する。

- チーム、ボンディング、または VLAN デバイスをチームのポートとして使用するには、これらのデバイスがまだ設定されていないことを確認してください。

手順

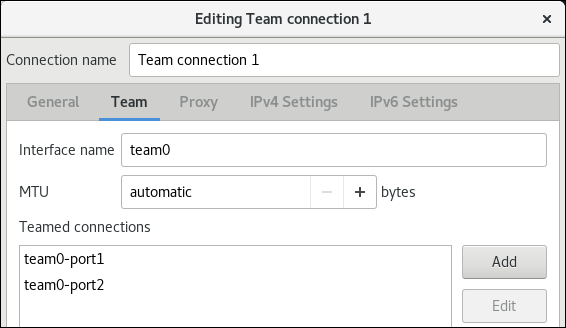

ターミナルを開き、

nm-connection-editorと入力します。$ nm-connection-editor- ボタンをクリックして、新しい接続を追加します。

- 接続タイプ Team を選択し、 をクリックします。

Team タブで、以下を行います。

- 必要に応じて、Interface name フィールドにチームインターフェイスの名前を設定します。

ボタンをクリックして、ネットワークインターフェイスの新しい接続プロファイルを追加し、プロファイルをポートとしてチームに追加します。

- インターフェイスの接続タイプを選択します。たとえば、有線接続に Ethernet を選択します。

- 必要に応じて、ポートの接続名を設定します。

- イーサネットデバイスの接続プロファイルを作成する場合は、Ethernet タブを開き、Device フィールドでポートとしてチームに追加するネットワークインターフェイスを選択します。別のデバイスタイプを選択した場合は、それに応じて設定します。いずれの接続にも割り当てられていないチームのイーサネットインターフェイスのみを使用できる点に注意してください。

- をクリックします。

チームに追加する各インターフェイスに直前の手順を繰り返します。

ボタンをクリックして、チーム接続に高度なオプションを設定します。

- Runner タブで、ランナーを選択します。

- Link Watcher タブで、リンク監視とそのオプションを設定します。

- をクリックします。

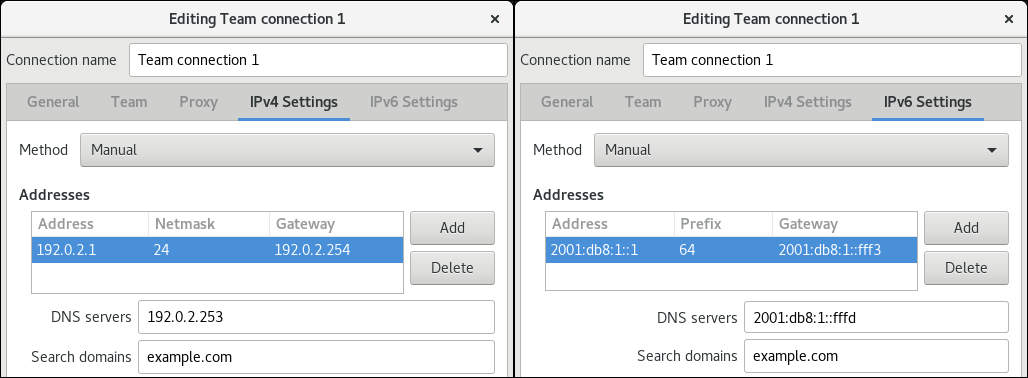

IPv4 Settings タブと IPv6 Settings タブの両方で IP アドレス設定を設定します。

- このブリッジデバイスを他のデバイスのポートとして使用する場合は、Method フィールドを Disabled に設定します。

- DHCP を使用するには、Method フィールドをデフォルトの Automatic (DHCP) のままにします。

静的 IP 設定を使用するには、Method フィールドを Manual に設定し、それに応じてフィールドに値を入力します。

- をクリックします。

-

nm-connection-editorを閉じます。

検証

チームのステータスを表示します。

# teamdctl team0 state setup: runner: activebackup ports: enp7s0 link watches: link summary: up instance[link_watch_0]: name: ethtool link: up down count: 0 enp8s0 link watches: link summary: up instance[link_watch_0]: name: ethtool link: up down count: 0 runner: active port: enp7s0

第5章 VLAN タグの設定

仮想ローカルエリアネットワーク (VLAN) は、物理ネットワーク内の論理ネットワークです。VLAN インターフェイスは、インターフェイスを通過する際に VLAN ID でパケットをタグ付けし、返信パケットのタグを削除します。

VLAN インターフェイスは、イーサネット、ボンディング、ブリッジデバイスなど、別のインターフェイスの上に作成します。これらのインターフェイスは parent interface と呼ばれます。

Red Hat Enterprise Linux は、VLAN デバイスを設定するためのさまざまなオプションを管理者に提供します。以下に例を示します。

-

nmcliを使用し、コマンドラインを使用して VLAN のタグ付けを設定します。 - RHEL Web コンソールを使用し、Web ブラウザーを使用して VLAN のタグ付けを設定します。

-

nmtuiを使用し、テキストベースのユーザーインターフェイスで VLAN のタグ付けを設定します。 -

nm-connection-editorアプリケーションを使用して、グラフィカルインターフェイスで接続を設定します。 -

nmstatectlを使用して、Nmstate API を介して接続を設定します。 - RHEL システムロールを使用して、1 つまたは複数のホストで VLAN 設定を自動化します。

5.1. nmcli を使用した VLAN タグ付けの設定

nmcli ユーティリティーを使用して、コマンドラインで仮想ローカルエリアネットワーク (VLAN) のタグ付けを設定できます。

前提条件

- 仮想 VLAN インターフェイスに対する親として使用するインターフェイスが VLAN タグに対応している。

ボンドインターフェイスに VLAN を設定する場合は、以下のようになります。

- ボンディングのポートが起動している。

-

ボンドが、

fail_over_mac=followオプションで設定されていない。VLAN 仮想デバイスは、親の新規 MAC アドレスに一致する MAC アドレスを変更できません。このような場合、トラフィックは間違ったソースの MAC アドレスで送信されます。 -

ボンドは通常、DHCP サーバーまたは IPv6 自動設定から IP アドレスを取得することは想定されていません。ボンディングの作成時に

ipv4.method=disableオプションおよびipv6.method=ignoreオプションを設定してこれを確認します。そうしないと、DHCP または IPv6 の自動設定がしばらくして失敗した場合に、インターフェイスがダウンする可能性があります。

- ホストが接続するスイッチは、VLAN タグに対応するように設定されています。詳細は、スイッチのドキュメントを参照してください。

手順

ネットワークインターフェイスを表示します。

# nmcli device status DEVICE TYPE STATE CONNECTION enp1s0 ethernet disconnected enp1s0 bridge0 bridge connected bridge0 bond0 bond connected bond0 ...VLAN インターフェイスを作成します。たとえば、VLAN インターフェイス

vlan10を作成し、enp1s0を親インターフェイスとして使用し、VLAN ID10のタグパケットを作成するには、次のコマンドを実行します。# nmcli connection add type vlan con-name vlan10 ifname vlan10 vlan.parent enp1s0 vlan.id 10VLAN は、

0から4094の範囲内に存在する必要があります。デフォルトでは、VLAN 接続は、親インターフェイスから最大伝送単位 (MTU) を継承します。必要に応じて、別の MTU 値を設定します。

# nmcli connection modify vlan10 ethernet.mtu 2000IPv4 を設定します。

静的 IPv4 アドレス、ネットワークマスク、デフォルトゲートウェイ、および DNS サーバーを

vlan10接続に設定するには、次のように実行します。# nmcli connection modify vlan10 ipv4.addresses '192.0.2.1/24' ipv4.gateway '192.0.2.254' ipv4.dns '192.0.2.253' ipv4.method manual- DHCP を使用するために必要な操作はありません。

- この VLAN デバイスを他のデバイスのポートとして使用する予定の場合は、何もする必要はありません。

IPv6 設定を行います。

静的 IPv6 アドレス、ネットワークマスク、デフォルトゲートウェイ、および DNS サーバーを

vlan10接続に設定するには、次のように実行します。# nmcli connection modify vlan10 ipv6.addresses '2001:db8:1::1/32' ipv6.gateway '2001:db8:1::fffe' ipv6.dns '2001:db8:1::fffd' ipv6.method manual- ステートレスアドレス自動設定 (SLAAC) を使用する場合、アクションは必要ありません。

- この VLAN デバイスを他のデバイスのポートとして使用する予定の場合は、何もする必要はありません。

接続をアクティベートします。

# nmcli connection up vlan10

検証

設定を確認します。

# ip -d addr show vlan10 4: vlan10@enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP group default qlen 1000 link/ether 52:54:00:72:2f:6e brd ff:ff:ff:ff:ff:ff promiscuity 0 vlan protocol 802.1Q id 10 <REORDER_HDR> numtxqueues 1 numrxqueues 1 gso_max_size 65536 gso_max_segs 65535 inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute vlan10 valid_lft forever preferred_lft forever inet6 2001:db8:1::1/32 scope global noprefixroute valid_lft forever preferred_lft forever inet6 fe80::8dd7:9030:6f8e:89e6/64 scope link noprefixroute valid_lft forever preferred_lft forever

5.2. nmcli を使用したネストされた VLAN の設定

802.1ad は、仮想ローカルエリアネットワーク (VLAN) のタグ付けに使用されるプロトコルです。これは Q-in-Q タグ付けとしても知られています。この技術を使用すると、1 つのイーサネットフレーム内に複数の VLAN タグを作成できます。

1 つのイーサネットフレーム内に複数の VLAN タグを作成する利点:

- VLAN 内に複数の分離ネットワークセグメントを作成することで、ネットワークのスケーラビリティーが向上します。これにより、大規模なネットワークを、より小さく管理可能なユニットに分割して整理できます。

- さまざまな種類のネットワークトラフィックを分離および制御することで、トラフィック管理が改善されました。これにより、ネットワークパフォーマンスが向上し、ネットワークの輻輳を減らすことができます。

- より小規模で、よりターゲットを絞ったネットワークセグメントの作成を可能にすることで、リソースを効率的に利用します。

- ネットワークトラフィックを分離し、機密データへの不正アクセスのリスクを軽減することで、セキュリティーを強化します。

前提条件

- 仮想 VLAN インターフェイスに対する親として使用するインターフェイスが VLAN タグに対応している。

ボンドインターフェイスに VLAN を設定する場合は、以下のようになります。

- ボンディングのポートが起動している。

-

ボンドが、

fail_over_mac=followオプションで設定されていない。VLAN 仮想デバイスは、親の新規 MAC アドレスに一致する MAC アドレスを変更できません。このような場合、トラフィックは間違ったソースの MAC アドレスで送信されます。 -

ボンドは通常、DHCP サーバーまたは IPv6 自動設定から IP アドレスを取得することは想定されていません。ボンディングの作成時に

ipv4.method=disableオプションおよびipv6.method=ignoreオプションを設定してこれを確認します。そうしないと、DHCP または IPv6 の自動設定がしばらくして失敗した場合に、インターフェイスがダウンする可能性があります。

- ホストが接続するスイッチは、VLAN タグに対応するように設定されています。詳細は、スイッチのドキュメントを参照してください。

手順

物理ネットワークデバイスを表示します。

# nmcli device status DEVICE TYPE STATE CONNECTION enp1s0 ethernet connected enp1s0 ...ベース VLAN インターフェイスを作成します。たとえば、

enp1s0を親インターフェイスとして使用し、パケットに VLAN ID10のタグを付けるvlan10という名前のベース VLAN インターフェイスを作成するには、次のように実行します。# nmcli connection add type vlan con-name vlan10 dev enp1s0 vlan.id 10VLAN は、

0から4094の範囲内に存在する必要があります。デフォルトでは、VLAN 接続は、親インターフェイスから最大伝送単位 (MTU) を継承します。必要に応じて、別の MTU 値を設定します。

# nmcli connection modify vlan10 ethernet.mtu 2000ベース VLAN インターフェイスの上にネストされた VLAN インターフェイスを作成します。

# nmcli connection add type vlan con-name vlan10.20 dev enp1s0.10 id 20 vlan.protocol 802.1adこのコマンドは、親 VLAN 接続

vlan10で、名前がvlan10.20で VLAN ID が20の新しい VLAN 接続を作成します。devオプションは、親ネットワークデバイスを指定します。この場合、enp1s0.10です。vlan.protocolオプションは、VLAN カプセル化プロトコルを指定します。この場合、802.1ad(Q-in-Q) です。ネストされた VLAN インターフェイスの IPv4 設定を設定します。

- DHCP を使用するために必要な操作はありません。

静的 IPv4 アドレス、ネットワークマスク、デフォルトゲートウェイ、および DNS サーバーを

vlan10.20接続に設定するには、次のように実行します。# nmcli connection modify vlan10.20 ipv4.method manual ipv4.addresses 192.0.2.1/24 ipv4.gateway 192.0.2.254 ipv4.dns 192.0.2.200

ネストされた VLAN インターフェイスの IPv6 設定を設定します。

- ステートレスアドレス自動設定 (SLAAC) を使用する場合、アクションは必要ありません。

静的 IPv6 アドレス、ネットワークマスク、デフォルトゲートウェイ、および DNS サーバーを vlan10 接続に設定するには、次のように実行します。

# nmcli connection modify bridge0 ipv6.addresses '2001:db8:1::1/64' ipv6.gateway '2001:db8:1::fffe' ipv6.dns '2001:db8:1::fffd' ipv6.dns-search 'example.com' ipv6.method manual

プロファイルをアクティブ化します。

# nmcli connection up vlan10.20

検証

ネストされた VLAN インターフェイスの設定を確認します。

# ip -d addr show enp1s0.10.20 10: enp1s0.10.20@enp1s0.10: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP group default qlen 1000 link/ether 52:54:00:d2:74:3e brd ff:ff:ff:ff:ff:ff promiscuity 0 minmtu 0 maxmtu 65535 vlan protocol 802.1ad id 20 <REORDER_HDR> numtxqueues 1 numrxqueues 1 gso_max_size 65536 gso_max_segs 65535 tso_max_size 65536 tso_max_segs 65535 gro_max_size 65536 inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute enp1s0.10.20 valid_lft forever preferred_lft forever inet6 2001:db8:1::1/32 scope global noprefixroute valid_lft forever preferred_lft forever inet6 fe80::ce3b:84c5:9ef8:d0e6/64 scope link noprefixroute valid_lft forever preferred_lft forever

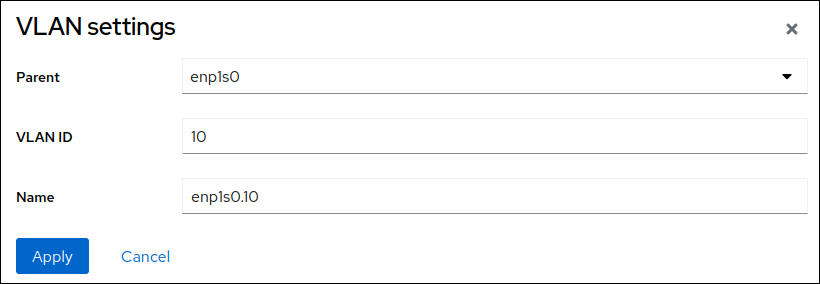

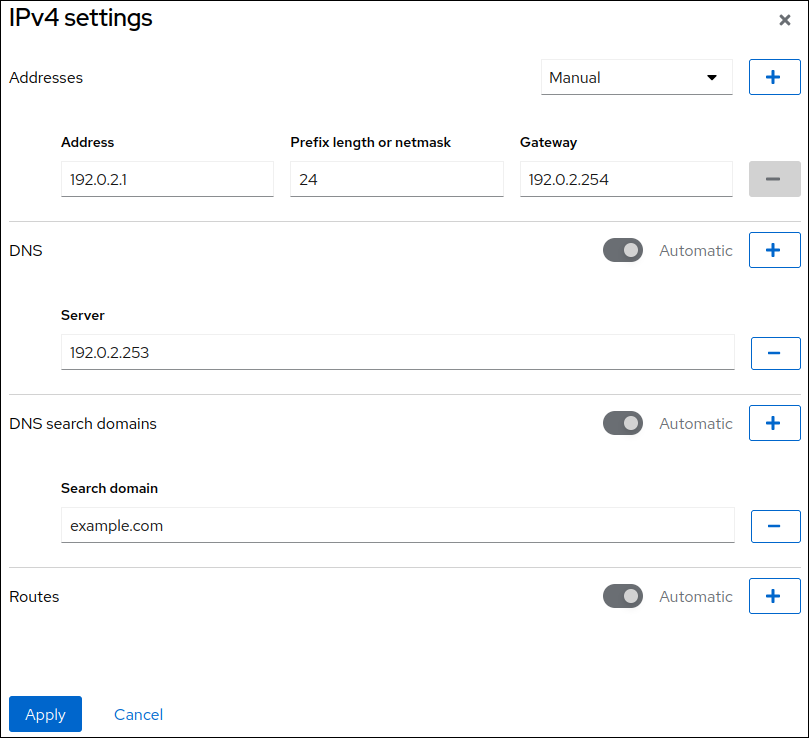

5.3. RHEL Web コンソールを使用した VLAN タグ付けの設定

RHEL Web コンソールで Web ブラウザーベースのインターフェイスを使用してネットワーク設定を管理する場合は、VLAN タグ付けを設定できます。

前提条件

- 仮想 VLAN インターフェイスに対する親として使用するインターフェイスが VLAN タグに対応している。

ボンドインターフェイスに VLAN を設定する場合は、以下のようになります。

- ボンディングのポートが起動している。

-

ボンドが、

fail_over_mac=followオプションで設定されていない。VLAN 仮想デバイスは、親の新規 MAC アドレスに一致する MAC アドレスを変更できません。このような場合、トラフィックは間違ったソースの MAC アドレスで送信されます。 - ボンドは通常、DHCP サーバーまたは IPv6 自動設定から IP アドレスを取得することは想定されていません。結合を作成する IPv4 および IPv6 プロトコルを無効にして、これを確認します。そうしないと、DHCP または IPv6 の自動設定がしばらくして失敗した場合に、インターフェイスがダウンする可能性があります。

- ホストが接続するスイッチは、VLAN タグに対応するように設定されています。詳細は、スイッチのドキュメントを参照してください。

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

-

画面左側のナビゲーションで

Networkingタブを選択します。 -

Interfacesセクションで をクリックします。 - 親デバイスを選択します。

- VLAN ID を入力します。

VLAN デバイスの名前を入力するか、自動生成された名前のままにします。

- をクリックします。

デフォルトでは、VLAN デバイスは動的 IP アドレスを使用します。静的 IP アドレスを設定する場合:

-

Interfacesセクションで VLAN デバイスの名前をクリックします。 -

設定するプロトコルの横にある

Editをクリックします。 -

Addressesの横にあるManualを選択し、IP アドレス、接頭辞、およびデフォルトゲートウェイを入力します。 -

DNSセクションで ボタンをクリックし、DNS サーバーの IP アドレスを入力します。複数の DNS サーバーを設定するには、この手順を繰り返します。 -

DNS search domainsセクションで、 ボタンをクリックし、検索ドメインを入力します。 インターフェイスにスタティックルートが必要な場合は、

Routesセクションで設定します。

- をクリックします。

-

検証

画面左側のナビゲーションで

Networkingタブを選択し、インターフェイスに着信および発信トラフィックがあるか確認します。

5.4. nmtui を使用した VLAN タグ付けの設定

nmtui アプリケーションは、NetworkManager 用のテキストベースのユーザーインターフェイスを提供します。nmtui を使用して、グラフィカルインターフェイスを使用せずにホスト上で VLAN タグ付けを設定できます。

nmtui の操作方法は次のとおりです。

- カーソルキーを使用してナビゲートします。

- ボタンを選択して Enter を押します。

- Space を使用してチェックボックスをオンまたはオフにします。

- 前の画面に戻るには、ESC を使用します。

前提条件

- 仮想 VLAN インターフェイスに対する親として使用するインターフェイスが VLAN タグに対応している。

ボンドインターフェイスに VLAN を設定する場合は、以下のようになります。

- ボンディングのポートが起動している。

-

ボンドが、

fail_over_mac=followオプションで設定されていない。VLAN 仮想デバイスは、親の新規 MAC アドレスに一致する MAC アドレスを変更できません。このような場合、トラフィックは間違ったソースの MAC アドレスで送信されます。 -

ボンドは通常、DHCP サーバーまたは IPv6 自動設定から IP アドレスを取得することは想定されていません。ボンディングの作成時に

ipv4.method=disableオプションおよびipv6.method=ignoreオプションを設定してこれを確認します。そうしないと、DHCP または IPv6 の自動設定がしばらくして失敗した場合に、インターフェイスがダウンする可能性があります。

- ホストが接続するスイッチは、VLAN タグに対応するように設定されています。詳細は、スイッチのドキュメントを参照してください。

手順

VLAN タグ付けを設定するネットワークデバイス名がわからない場合は、使用可能なデバイスを表示します。

# nmcli device status DEVICE TYPE STATE CONNECTION enp1s0 ethernet unavailable -- ...nmtuiを開始します。# nmtui- Edit a connection を選択し、Enter を押します。

- Add を押します。

- ネットワークタイプのリストから VLAN を選択し、Enter を押します。

オプション: 作成する NetworkManager プロファイルの名前を入力します。

ホストに複数のプロファイルがある場合は、わかりやすい名前を付けると、プロファイルの目的を識別しやすくなります。

- 作成する VLAN デバイス名を Device フィールドに入力します。

- VLAN タグ付けを設定するデバイスの名前を Parent フィールドに入力します。

-

VLAN ID を入力します。ID は

0から4094の範囲内である必要があります。 環境に応じて、IPv4 configuration および IPv6 configuration 領域に IP アドレス設定を設定します。これを行うには、これらの領域の横にあるボタンを押して、次を選択します。

-

この VLAN デバイスが IP アドレスを必要としない場合、または他のデバイスのポートとして使用する場合は、

Disabledにします。 -

DHCP サーバーまたはステートレスアドレス自動設定 (SLAAC) が IP アドレスを VLAN デバイスに動的に割り当てる場合は、

Automaticにします。 ネットワークで静的 IP アドレス設定が必要な場合は、

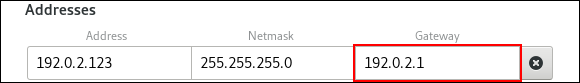

Manualにします。この場合、さらにフィールドに入力する必要があります。- 設定するプロトコルの横にある Show を押して、追加のフィールドを表示します。

Addresses の横にある Add を押して、IP アドレスとサブネットマスクを Classless Inter-Domain Routing (CIDR) 形式で入力します。

サブネットマスクを指定しない場合、NetworkManager は IPv4 アドレスに

/32サブネットマスクを設定し、IPv6 アドレスに/64サブネットマスクを設定します。- デフォルトゲートウェイのアドレスを入力します。

- DNS servers の横にある Add を押して、DNS サーバーのアドレスを入力します。

- Search domains の横にある Add を押して、DNS 検索ドメインを入力します。

図5.1 静的 IP アドレス設定による VLAN 接続例

-

この VLAN デバイスが IP アドレスを必要としない場合、または他のデバイスのポートとして使用する場合は、

- OK を押すと、新しい接続が作成され、自動的にアクティブ化されます。

- Back を押してメインメニューに戻ります。

-

Quit を選択し、Enter キーを押して

nmtuiアプリケーションを閉じます。

検証

設定を確認します。

# ip -d addr show vlan10 4: vlan10@enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP group default qlen 1000 link/ether 52:54:00:72:2f:6e brd ff:ff:ff:ff:ff:ff promiscuity 0 vlan protocol 802.1Q id 10 <REORDER_HDR> numtxqueues 1 numrxqueues 1 gso_max_size 65536 gso_max_segs 65535 inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute vlan10 valid_lft forever preferred_lft forever inet6 2001:db8:1::1/32 scope global noprefixroute valid_lft forever preferred_lft forever inet6 fe80::8dd7:9030:6f8e:89e6/64 scope link noprefixroute valid_lft forever preferred_lft forever

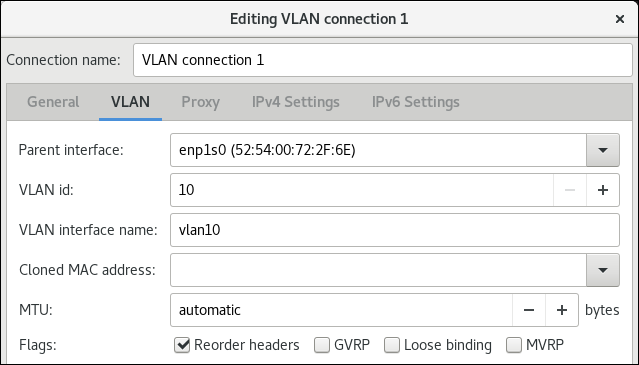

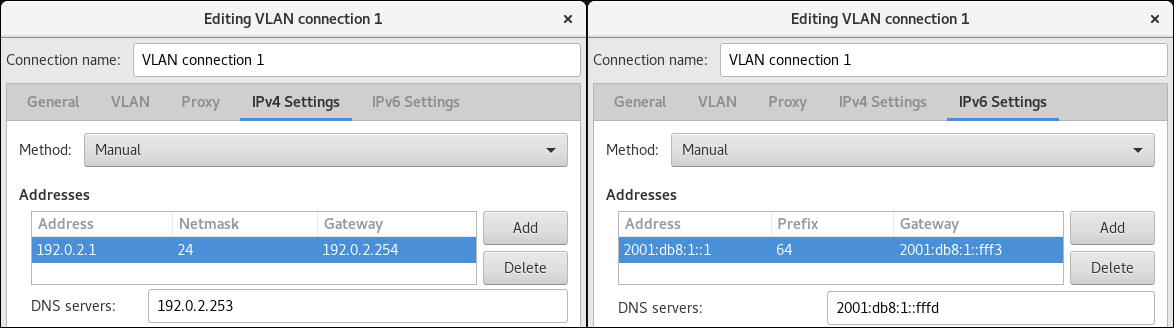

5.5. nm-connection-editor を使用した VLAN タグ付けの設定

nm-connection-editor アプリケーションを使用して、グラフィカルインターフェイスで仮想ローカルエリアネットワーク (VLAN) のタグ付けを設定できます。

前提条件

- 仮想 VLAN インターフェイスに対する親として使用するインターフェイスが VLAN タグに対応している。

ボンドインターフェイスに VLAN を設定する場合は、以下のようになります。

- ボンディングのポートが起動している。

-

ボンドが、

fail_over_mac=followオプションで設定されていない。VLAN 仮想デバイスは、親の新規 MAC アドレスに一致する MAC アドレスを変更できません。このような場合、トラフィックは間違ったソースの MAC アドレスで送信されます。

- ホストが接続するスイッチは、VLAN タグに対応するように設定されています。詳細は、スイッチのドキュメントを参照してください。

手順

ターミナルを開き、

nm-connection-editorと入力します。$ nm-connection-editor- ボタンをクリックして、新しい接続を追加します。

- VLAN 接続タイプを選択し、 をクリックします。

VLAN タブで、以下を行います。

- 親インターフェイスを選択します。

- VLAN id を選択します。VLAN は、0 から 4094 の範囲内に存在する必要があります。

- デフォルトでは、VLAN 接続は、親インターフェイスから最大伝送単位 (MTU) を継承します。必要に応じて、別の MTU 値を設定します。

オプション: VLAN インターフェイスの名前および VLAN 固有のオプションを設定します。

IPv4 Settings タブと IPv6 Settings タブの両方で IP アドレス設定を設定します。

- このブリッジデバイスを他のデバイスのポートとして使用する場合は、Method フィールドを Disabled に設定します。

- DHCP を使用するには、Method フィールドをデフォルトの Automatic (DHCP) のままにします。

静的 IP 設定を使用するには、Method フィールドを Manual に設定し、それに応じてフィールドに値を入力します。

- をクリックします。

-

nm-connection-editorを閉じます。

検証

設定を確認します。

# ip -d addr show vlan10 4: vlan10@enp1s0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP group default qlen 1000 link/ether 52:54:00:d5:e0:fb brd ff:ff:ff:ff:ff:ff promiscuity 0 vlan protocol 802.1Q id 10 <REORDER_HDR> numtxqueues 1 numrxqueues 1 gso_max_size 65536 gso_max_segs 65535 inet 192.0.2.1/24 brd 192.0.2.255 scope global noprefixroute vlan10 valid_lft forever preferred_lft forever inet6 2001:db8:1::1/32 scope global noprefixroute valid_lft forever preferred_lft forever inet6 fe80::8dd7:9030:6f8e:89e6/64 scope link noprefixroute valid_lft forever preferred_lft forever

5.6. nmstatectl を使用した VLAN タグ付けの設定

宣言型の Nmstate API を使用して、仮想ローカルエリアネットワーク VLAN を設定できます。Nmstate を使用すると、結果が必ず設定ファイルと一致したものになります。一致しない場合は、変更がロールバックされます。

環境に応じて、YAML ファイルを適宜調整します。たとえば、VLAN でイーサネットアダプターとは異なるデバイスを使用するには、VLAN で使用するポートの base-iface 属性と type 属性を調整します。

前提条件

- イーサネットデバイスを VLAN のポートとして使用するために、物理または仮想イーサネットデバイスがサーバーにインストールされている。

-

nmstateパッケージがインストールされている。

手順

以下の内容を含む YAML ファイル (例: