仮想化の設定および管理

ホストのセットアップ、仮想マシンの作成と管理、仮想化機能の詳細

概要

Red Hat ドキュメントへのフィードバック (英語のみ)

Red Hat は質の高いドキュメントを提供することに尽力しており、皆様からのフィードバックを大切にしています。改善にご協力いただくため、Red Hat Jira トラッキングシステムを通じてご提案やエラー報告をお寄せください。

手順

Jira の Web サイトにログインします。

アカウントがない場合、アカウント作成オプションを選択します。

- 上部のナビゲーションバーで Create をクリックします。

- Summary フィールドにわかりやすいタイトルを入力します。

- Description フィールドに、ドキュメントの改善に関するご意見を記入してください。ドキュメントの該当部分へのリンクも追加してください。

- ダイアログの下部にある Create をクリックします。

第1章 RHEL における仮想化について

この章では、仮想化の概念や、Linux における仮想化の実装に参考になるように、RHEL 9 における仮想化の概要、基本な内容、利点、コンポーネントなど、Red Hat が提供する仮想化ソリューションを説明します。

1.1. 仮想化とは

RHEL 9 では 仮想化機能 が提供され、RHEL 9 を実行するマシンが、複数の仮想マシン (VM) (ゲスト とも呼ばれます) を ホスト できるようにします。仮想マシンは、ホストの物理ハードウェアとコンピューティングリソースを使用して、独立した仮想化オペレーティングシステム (ゲスト OS) を、ホストのオペレーティングシステムのユーザー空間プロセスとして実行します

つまり、仮想化により、オペレーティングシステム内にオペレーティングシステムを追加できます。

仮想マシンを使用すると、ソフトウェアの設定や機能を安全にテストしたり、レガシーソフトウェアを実行したり、ハードウェアのワークロードの効率を最適化したりできます。利点の詳細は、仮想化の利点 を参照してください。

仮想化の詳細は、仮想化のトピックページ を参照してください。

次のステップ

- Red Hat Enterprise Linux 9 で仮想化の使用を開始するには、Red Hat Enterprise Linux 9 での 仮想化の有効化 を参照してください。

- Red Hat は、Red Hat Enterprise Linux 9 の仮想化以外にも、専門化した仮想化ソリューションを多数提供しています。各ソリューションには、さまざまなユーザーフォーカスおよび機能があります。詳細は、Red Hat virtualization solutions を参照してください。

1.2. 仮想化の利点

仮想マシンの使用には、物理マシンを使用する場合と比較して、以下の利点があります。

リソースの柔軟性と詳細な割り当て

仮想マシンは、通常、物理マシンであるホストマシンで稼働し、使用するゲスト OS に物理ハードウェアを割り当てることもできます。ただし、仮想マシンへの物理リソースの割り当てはソフトウェアレベルで行うため、柔軟性が非常に高くなります。仮想マシンは、ホストメモリー、CPU、またはストレージ領域で設定可能な割合を指定して、非常に詳細なリソース要求を指定できます。

たとえば、ゲスト OS がディスクとして見るものは、ホストファイルシステムではファイルとして表示され、そのディスクのサイズは、物理ディスクで利用可能なサイズよりも少なくなります。

ソフトウェアで制御される設定

仮想マシン全体の設定は、ホスト上のデータとして保存され、ソフトウェア制御下にあります。したがって、仮想マシンの作成、削除、クローン作成、移行、リモートからの操作、リモートストレージへの接続などを簡単に行うことができます。

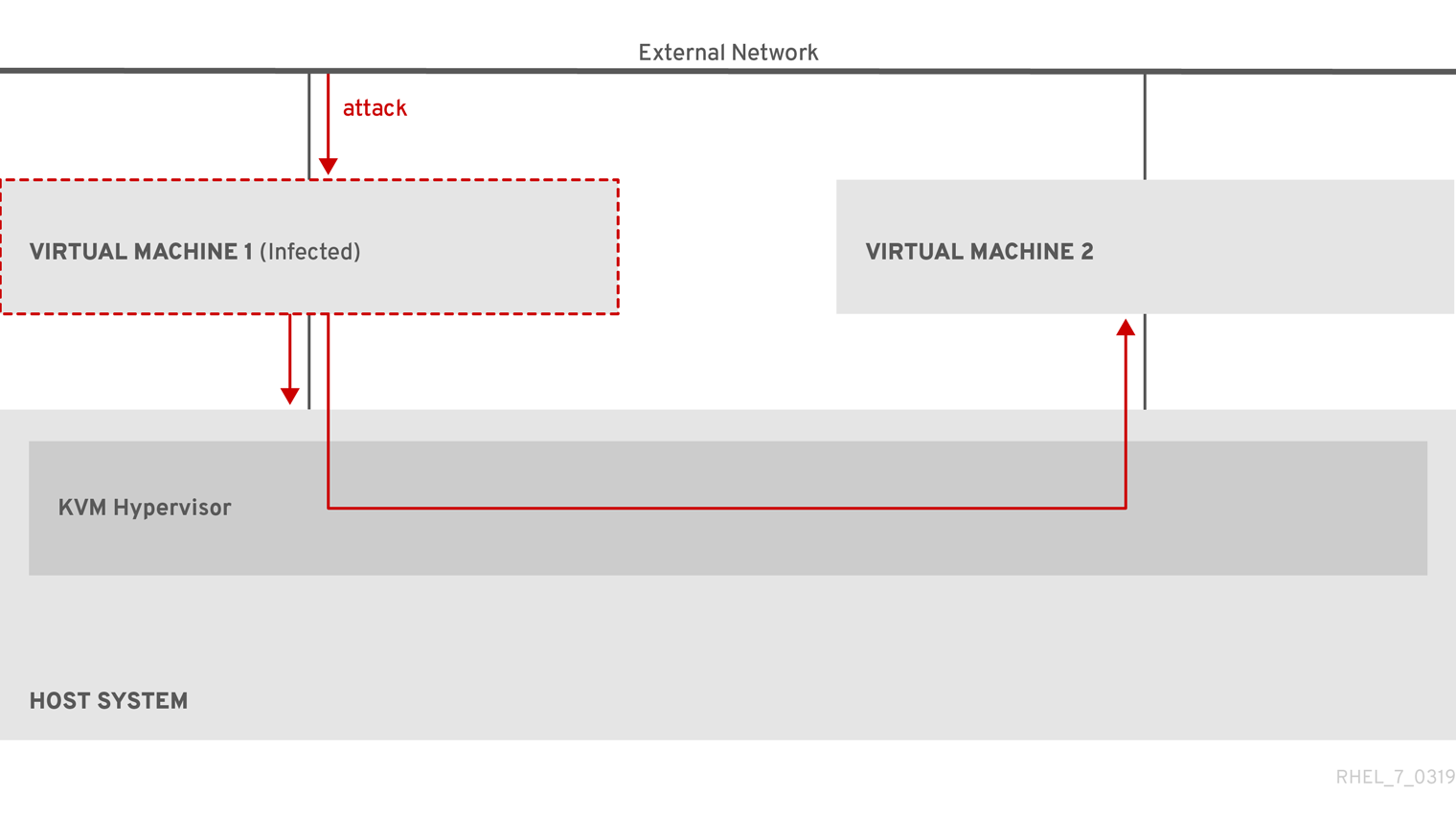

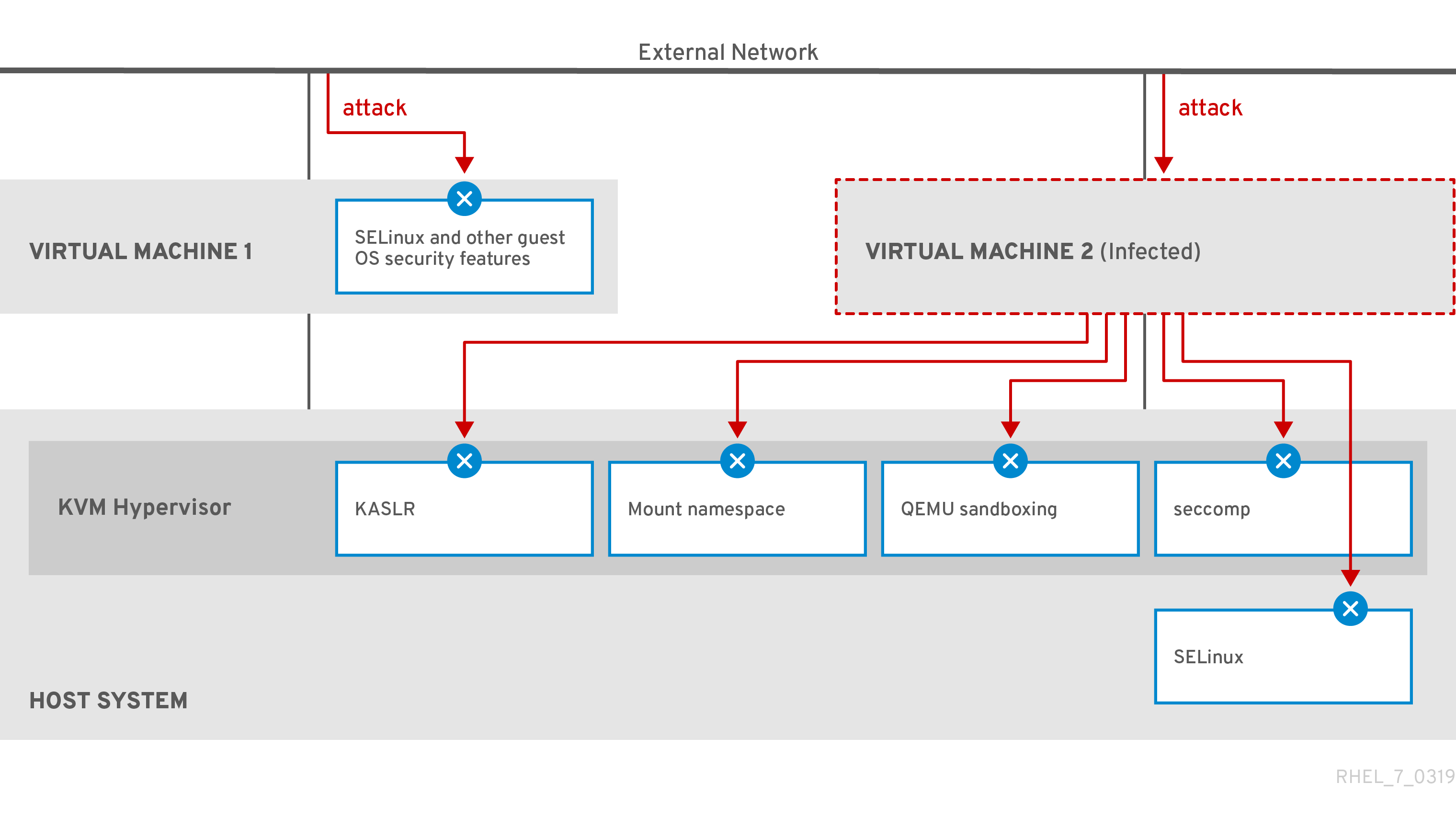

ホストからの分離

ゲスト OS は、ホストの OS とは別の仮想化カーネルで実行します。つまり、任意の OS を仮想マシンにインストールでき、ゲスト OS が不安定になっても、または不正アクセスされても、ホストには影響を及ぼしません。

領域とコスト効率

1 台の物理マシンで仮想マシンを多数ホストできます。したがって、複数の物理マシンが同じタスクを実行する必要がないため、物理ハードウェアに対する領域、電力、およびメンテナンスの要件が低くなります。

ソフトウェアの互換性

仮想マシンは、ホストとは異なる OS を使用できるため、仮想化により、本来はホスト OS 用にリリースされていないアプリケーションを実行できるようになります。たとえば、RHEL 7 のゲスト OS を使用すると、RHEL 7 用にリリースされたアプリケーションを RHEL 9 ホストシステムで実行できます。

注記RHEL 9 ホストでは、すべてのオペレーティングシステムがゲスト OS としてサポートされているわけではありません。詳細は、Recommended features in RHEL 9 virtualization を参照してください。

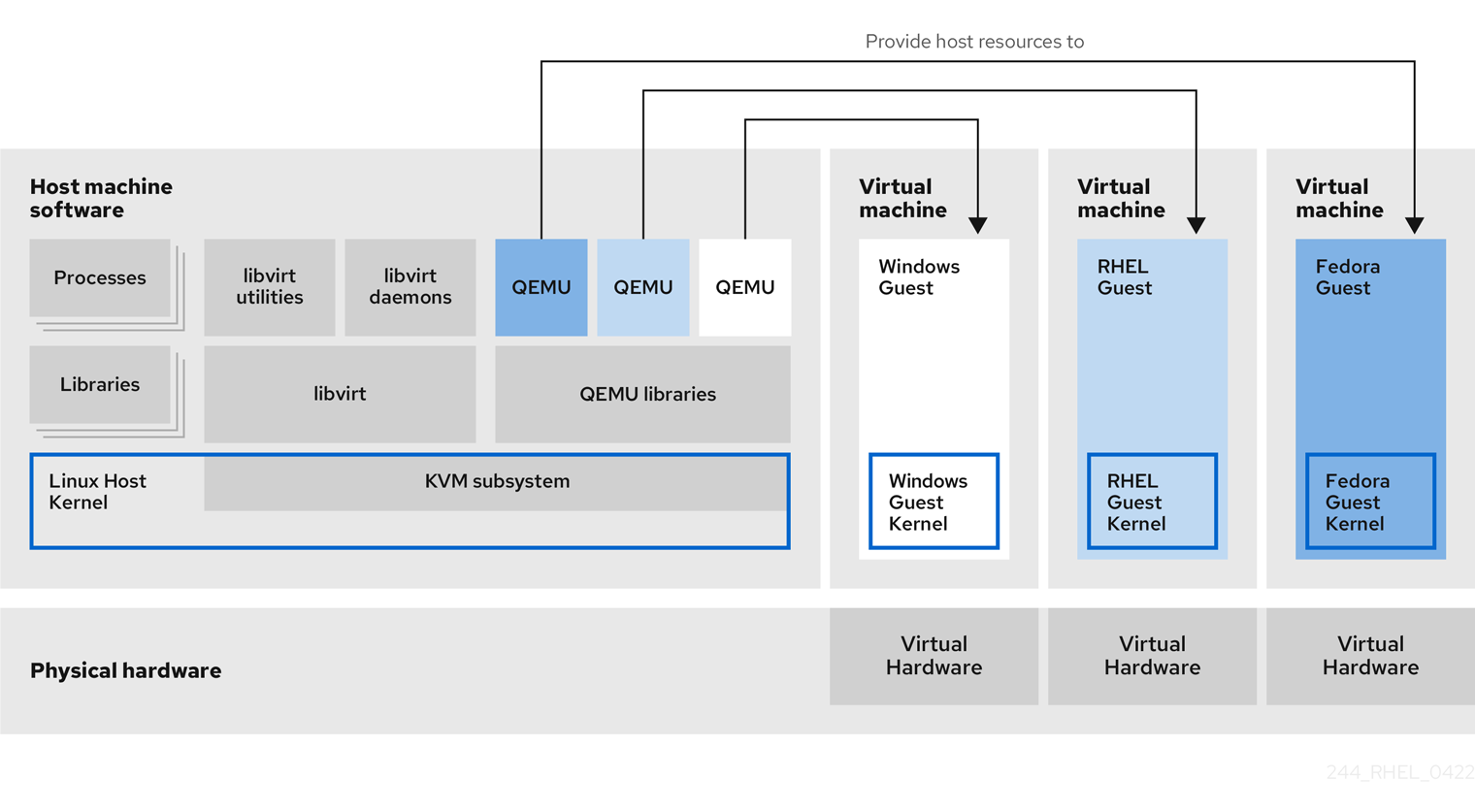

1.3. 仮想マシンコンポーネントおよびその相互作用

RHEL 9 の仮想化は、次の主要なソフトウェアコンポーネントで構成されています。

ハイパーバイザー

RHEL 9 で仮想マシンを作成する基礎となる部分は、ハードウェアを制御し、ホストマシンで複数のオペレーティングシステムを実行できるようにするソフトウェア層で、ハイパーバイザー と呼ばれます。

ハイパーバイザーには、KVM (Kernel-based Virtual Machine) モジュールと仮想化カーネルドライバーが含まれます。このコンポーネントでは、ホストマシンの Linux カーネルにより、ユーザー空間のソフトウェアに仮想化のリソースが提供されます。

ユーザー空間レベルでは、QEMU エミュレーターが、ゲスト OS を実行できる完全に仮想化されたハードウェアプラットフォームをシミュレートし、リソースがホストでどのように割り当てられ、ゲストに示されるかを管理します。

さらに、libvirt ソフトウェアスイートが管理層および通信層として機能し、QEMU とのやり取りを容易にし、セキュリティールールを適用し、仮想マシンを設定して実行するための追加ツールを多数提供します。

XML 設定

ホストベースの XML 設定ファイル (ドメイン XML ファイルとも呼ばれます) では、個別の仮想マシンの設定およびデバイスをすべて決定します。設定には以下が含まれます。

- メタデータ (仮想マシンの名前、タイムゾーン、その他の仮想マシンの情報など)

- 仮想マシンのデバイスの説明 (仮想 CPU (vCPU)、ストレージデバイス、入出力デバイス、ネットワークインターフェイスカード、その他の物理ハードウェアおよび仮想ハードウェアなど)

- 仮想マシンの設定 (使用可能な最大メモリー量、再起動設定、仮想マシンの動作に関するその他の設定など)

XML 設定の内容の詳細は、仮想マシンの XML 設定例 を参照してください。

コンポーネントのインタラクション

仮想マシンが起動すると、ハイパーバイザーは XML 設定を使用して、ホストのユーザー空間プロセスとして仮想マシンのインスタンスを作成します。ハイパーバイザーは、仮想マシンプロセスが、ホストベースのインターフェイス (virsh ユーティリティー、virt-install ユーティリティー、guestfish ユーティリティー、Web コンソールの GUI など) にアクセスできるようにします。

このような仮想化ツールを使用すると、libvirt が、入力を QEMU の命令に変換します。QEMU が命令を KVM に伝え、カーネルが命令を実行するのに必要なリソースを適切に割り当てるようになります。これにより、QEMU が、仮想マシンの作成や修正、仮想マシンのオペレーティングシステムでのアクションの実行など、対応するユーザー空間を変更します。

QEMU はアーキテクチャーの必須コンポーネントですが、セキュリティーに関する懸念があるため、RHEL 9 システムで直接使用することは意図されていません。したがって、Red Hat は、qemu-* コマンドをサポート対象外としており、libvirt を使用して QEMU と相互作用することを強く推奨します。

ホストベースのインターフェイスの詳細は、仮想管理に使用するツールおよびインターフェイス を参照してください。

図1.1 RHEL 9 の仮想アーキテクチャー

1.4. 仮想管理に使用するツールおよびインターフェイス

RHEL 9 の仮想化は、コマンドライン (CLI) または複数のグラフィカルユーザーインターフェイス (GUI) を使用して管理できます。

コマンドラインインターフェイス

CLI は、RHEL 9 で仮想化を管理する最も強力な方法です。仮想マシン (VM) 管理用の CLI コマンドでは、以下のものがよく知られています。

virsh - 指定した引数に応じて、多種多様な目的を持つ多目的仮想コマンドラインユーティリティーおよびシェル。以下に例を示します。

-

仮想マシンの起動およびシャットダウン -

virsh startおよびvirsh shutdown -

利用可能な仮想マシンのリスト表示 -

virsh list -

設定ファイルからの仮想マシンの作成 -

virsh create -

仮想化シェルの入力 -

virsh

詳細は、システム上の

virsh(1)man ページを参照してください。-

仮想マシンの起動およびシャットダウン -

-

virt-install- 新しい仮想マシンを作成する CLI ユーティリティー。詳細は、システム上のvirt-install(1)man ページを参照してください。 -

virt-xml- 仮想マシンの設定を編集するユーティリティー。 -

guestfish- 仮想マシンのディスクイメージを調べ、修正するユーティリティー。詳細は、システム上のguestfish(1)man ページを参照してください。

グラフィカルユーザーインターフェイス

以下の GUI を使用して、RHEL 9 で仮想化を管理できます。

RHEL 9 の Web コンソール (Cockpit とも呼ばれています) は、仮想マシンおよび仮想化ホストの管理用に、リモートからアクセスでき、簡単に使用できるグラフィカルユーザーインターフェイスを提供します。

Web コンソールを使用した基本的な仮想化管理の手順は、Managing virtual machines in the web console を参照してください。

1.5. Red Hat の仮想化ソリューション

以下の Red Hat 製品は、RHEL 9 仮想化機能に構築されており、RHEL 9 で利用可能な KVM 仮想化機能を拡張します。また、RHEL 9 仮想化の制限 の多くが、このような製品には適用されません。

- OpenShift Virtualization

KubeVirt テクノロジーに基づいて、OpenShift Virtualization は Red Hat OpenShift Container Platform の一部であり、仮想マシンをコンテナーで実行することができます。

OpenShift Virtualization の詳細は、Red Hat ハイブリッドクラウド のページを参照してください。

- Red Hat OpenStack Platform (RHOSP)

Red Hat OpenStack Platform は、安全で信頼性の高いパブリックまたはプライベートの OpenStack クラウドを作成、デプロイ、および拡張するための統合基盤を提供します。

Red Hat OpenStack Platform の詳細は、Red Hat カスタマーポータル または Red Hat OpenStack Platform ドキュメントスイート を参照してください。

RHEL ではサポートされていませんが、他の Red Hat 仮想化ソリューションでサポートされている仮想化機能の詳細は、RHEL 9 仮想化で対応していない機能 を参照してください。

第2章 仮想化の有効化

RHEL 9 で仮想化を使用するには、仮想化パッケージをインストールして、仮想マシンをホストするようにシステムを設定する必要があります。これを行うための具体的な手順は、CPU アーキテクチャーによって異なります。

2.1. AMD64 および Intel 64 での仮想化の有効化

KVM ハイパーバイザーを設定し、RHEL 9 を実行している AMD64 または Intel 64 システムで仮想マシンを作成するには、以下の手順に従います。

前提条件

- Red Hat Enterprise Linux 9 が、ホストマシンに インストールされ登録されている。

システムが仮想ホストとして機能するように、以下のハードウェア要件を満たしている。

- ホストマシンのアーキテクチャーが KVM 仮想化 に対応している。

最低でも、以下のシステムリソースが利用できる。

- ホスト用に 6 GB と、各仮想マシン用に 6 GB の空きディスク容量。

- ホスト用に 2 GB と、各仮想マシン用に 2 GB の RAM。

- ホスト上の 4 つの CPU通常、仮想マシンは、割り当てられた 1 つの vCPU で実行できますが、Red Hat は、高負荷時に仮想マシンが応答しなくならないように、仮想マシンごとに 2 つ以上の vCPU を割り当てることを推奨します。

手順

仮想化ハイパーバイザーパッケージをインストールします。

# dnf install qemu-kvm libvirt virt-install virt-viewer仮想化サービスを起動します。

# for drv in qemu network nodedev nwfilter secret storage interface; do systemctl start virt${drv}d{,-ro,-admin}.socket; done

検証

システムが仮想ホストとして準備されていることを確認します。

# virt-host-validate [...] QEMU: Checking for device assignment IOMMU support : PASS QEMU: Checking if IOMMU is enabled by kernel : WARN (IOMMU appears to be disabled in kernel. Add intel_iommu=on to kernel cmdline arguments) LXC: Checking for Linux >= 2.6.26 : PASS [...] LXC: Checking for cgroup 'blkio' controller mount-point : PASS LXC: Checking if device /sys/fs/fuse/connections exists : FAIL (Load the 'fuse' module to enable /proc/ overrides)virt-host-validate のすべての項目で

PASS値が返された場合は、システムに 仮想マシンを作成する 準備ができています。いずれかの項目で

FAILが返された場合は、表示される指示に従って問題を解決してください。いずれかの項目で

WARNが返された場合は、表示される指示に従って仮想化機能を向上させることを検討してください。

トラブルシューティング

KVM 仮想化がホスト CPU でサポートされていない場合は、virt-host-validate は以下の出力を生成します。

QEMU: Checking for hardware virtualization: FAIL (Only emulated CPUs are available, performance will be significantly limited)ただし、このようなホストシステムにある仮想マシンは、パフォーマンス上の問題が発生するのではなく、起動に失敗します。

これを回避するには、仮想マシンの XML 設定の

<domain type>値をqemuに変更します。ただし、Red Hat はqemuドメインタイプを使用する仮想マシンに対応していないため、実稼働環境ではこれを設定しないことを強く推奨している点に注意してください。

2.2. IBM Z での仮想化の有効化

KVM ハイパーバイザーを設定し、RHEL 9 を実行している IBM Z システムで仮想マシンを作成するには、以下の手順に従います。

前提条件

最低でも、以下のシステムリソースが利用できる。

- ホスト用に 6 GB と、各仮想マシン用に 6 GB の空きディスク容量。

- ホスト用に 2 GB と、各仮想マシン用に 2 GB の RAM。

- ホスト上の 4 つの CPU通常、仮想マシンは、割り当てられた 1 つの vCPU で実行できますが、Red Hat は、高負荷時に仮想マシンが応答しなくならないように、仮想マシンごとに 2 つ以上の vCPU を割り当てることを推奨します。

- IBM Z ホストシステムが IBM z14 CPU 以降を使用している。

RHEL 9 が論理パーティション (LPAR) にインストールされている。また、LPAR が start-interpretive execution (SIE) 仮想機能に対応している。

これを確認するには、

/proc/cpuinfoファイルでsieを検索します。# grep sie /proc/cpuinfo features : esan3 zarch stfle msa ldisp eimm dfp edat etf3eh highgprs te sie

手順

仮想化パッケージをインストールします。

# dnf install qemu-kvm libvirt virt-install仮想化サービスを起動します。

# for drv in qemu network nodedev nwfilter secret storage interface; do systemctl start virt${drv}d{,-ro,-admin}.socket; done

検証

システムが仮想ホストとして準備されていることを確認します。

# virt-host-validate [...] QEMU: Checking if device /dev/kvm is accessible : PASS QEMU: Checking if device /dev/vhost-net exists : PASS QEMU: Checking if device /dev/net/tun exists : PASS QEMU: Checking for cgroup 'memory' controller support : PASS QEMU: Checking for cgroup 'memory' controller mount-point : PASS [...]virt-host-validate のすべての項目で

PASS値が返された場合は、システムに 仮想マシンを作成する 準備ができています。いずれかの項目で

FAILが返された場合は、表示される指示に従って問題を解決してください。いずれかの項目で

WARNが返された場合は、表示される指示に従って仮想化機能を向上させることを検討してください。

トラブルシューティング

KVM 仮想化がホスト CPU でサポートされていない場合は、virt-host-validate は以下の出力を生成します。

QEMU: Checking for hardware virtualization: FAIL (Only emulated CPUs are available, performance will be significantly limited)ただし、このようなホストシステムにある仮想マシンは、パフォーマンス上の問題が発生するのではなく、起動に失敗します。

これを回避するには、仮想マシンの XML 設定の

<domain type>値をqemuに変更します。ただし、Red Hat はqemuドメインタイプを使用する仮想マシンに対応していないため、実稼働環境ではこれを設定しないことを強く推奨している点に注意してください。

2.3. ARM 64 での仮想化の有効化

RHEL 9 を実行する ARM 64 システム (AArch64 とも呼ばれます) 上で仮想マシン (VM) を作成するための KVM ハイパーバイザーをセットアップするには、以下の手順に従います。

前提条件

最低でも、以下のシステムリソースが利用できる。

- ホスト用に 6 GB と、各ゲスト用に 6 GB の空きディスク容量

- ホスト用に 4 GB の RAM と、対象のゲストごとにさらに 4 GB。

- ホスト上の 4 つの CPU通常、仮想マシンは、割り当てられた 1 つの vCPU で実行できますが、Red Hat は、高負荷時に仮想マシンが応答しなくならないように、仮想マシンごとに 2 つ以上の vCPU を割り当てることを推奨します。

手順

仮想化パッケージをインストールします。

# dnf install qemu-kvm libvirt virt-install仮想化サービスを起動します。

# for drv in qemu network nodedev nwfilter secret storage interface; do systemctl start virt${drv}d{,-ro,-admin}.socket; done

検証

システムが仮想ホストとして準備されていることを確認します。root で以下のコマンドを実行します。

# virt-host-validate [...] QEMU: Checking if device /dev/vhost-net exists : PASS QEMU: Checking if device /dev/net/tun exists : PASS QEMU: Checking for cgroup 'memory' controller support : PASS QEMU: Checking for cgroup 'memory' controller mount-point : PASS [...] QEMU: Checking for cgroup 'blkio' controller support : PASS QEMU: Checking for cgroup 'blkio' controller mount-point : PASS QEMU: Checking if IOMMU is enabled by kernel : PASSvirt-host-validate のすべての項目で

PASS値が返された場合は、システムに 仮想マシンを作成 できます。いずれかの項目で

FAILが返された場合は、表示される指示に従って問題を解決してください。いずれかの項目で

WARNが返された場合は、表示される指示に従って仮想化機能を向上させることを検討してください。

次のステップ

2.4. 仮想マシンでの QEMU ゲストエージェント機能の有効化

RHEL 9 システムでホストされている仮想マシンの特定の機能を使用するには、まず QEMU ゲストエージェント (GA) を使用するように仮想マシンを設定する必要があります。

これらの機能の完全なリストは、QEMU ゲストエージェントを必要とする仮想化機能 を参照してください。

仮想マシン上で QEMU GA を設定するために必要な具体的な手順は、仮想マシンが使用するゲストオペレーティングシステムによって異なります。

- Linux 仮想マシンの場合は、Linux ゲストでの QEMU ゲストエージェントの有効化 参照してください。

- Windows 仮想マシンの場合は、Windows ゲストでの QEMU ゲストエージェントの有効化 を参照してください。

2.4.1. Linux ゲストでの QEMU ゲストエージェントの有効化

RHEL ホストが Linux 仮想マシン上で 特定の操作のサブセット を実行できるようにするには、QEMU ゲストエージェント (GA) を有効にする必要があります。

実行中の仮想マシンとシャットダウンした仮想マシンの両方で、QEMU GA を有効にできます。

手順

QEMU GA の XML 設定ファイル (例:

qemuga.xml) を作成します。# touch qemuga.xmlファイルに以下の行を追加します。

<channel type='unix'> <source mode='bind' path='/var/lib/libvirt/qemu/f16x86_64.agent'/> <target type='virtio' name='org.qemu.guest_agent.0'/> </channel>XML ファイルを使用して、仮想マシンの設定に QEMU GA を追加します。

仮想マシンが実行中の場合は、次のコマンドを使用します。

# virsh attach-device <vm-name> qemuga.xml --live --config仮想マシンがシャットダウンされている場合は、次のコマンドを使用します。

# virsh attach-device <vm-name> qemuga.xml --config

Linux ゲストオペレーティングシステムで、QEMU GA をインストールします。

# dnf install qemu-guest-agentゲストで QEMU GA サービスを起動します。

# systemctl start qemu-guest-agent

検証

QEMU GA が Linux 仮想マシンで有効化および実行されていることを確認するには、次のいずれかを実行します。

-

ゲストオペレーティングシステムで、

systemctl status qemu-guest-agent | grep Loadedコマンドを使用します。出力にenabledが含まれる場合、仮想マシン上で QEMU GA がアクティブになっています。 -

ホストで

virsh domfsinfo <vm-name>コマンドを使用します。何らかの出力が表示された場合、指定した仮想マシン上で QEMU GA がアクティブになっています。

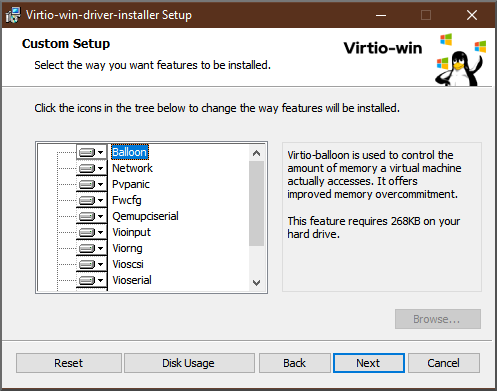

2.4.2. Windows ゲストでの QEMU ゲストエージェントの有効化

RHEL ホストが Windows 仮想マシン上で 特定の操作のサブセット を実行できるようにするには、QEMU ゲストエージェント (GA) を有効にする必要があります。これを行うには、QEMU ゲストエージェントインストーラーを含むストレージデバイスを、既存の仮想マシンに追加するか、新しい仮想マシンを作成するときに追加し、Windows ゲストオペレーティングシステムにドライバーをインストールします。

グラフィカルインターフェイスを使用してゲストエージェント (GA) をインストールするには、以下の手順を参照してください。コマンドラインで GA をインストールするには、Microsoft Windows Installer (MSI) を使用してください。

前提条件

- ゲストエージェントを含むインストールメディアが仮想マシンに接続されている。メディアの準備手順は、Preparing virtio driver installation media on a host machine を参照してください。

手順

-

Windows ゲストオペレーティングシステムで、

File Explorerアプリケーションを開きます。 -

この PCをクリックします。 -

デバイスおよびドライブペインで、virtio-winメディアを開きます。 -

guest-agentフォルダーを開きます。 仮想マシンにインストールされているオペレーティングシステムに基づいて、次のいずれかのインストーラーを実行します。

-

32 ビットオペレーティングシステムを使用している場合は、

qemu-ga-i386.msiインストーラーを実行します。 -

64 ビットオペレーティングシステムを使用している場合は、

qemu-ga-x86_64.msiインストーラーを実行します。

-

32 ビットオペレーティングシステムを使用している場合は、

-

オプション: ホストと Windows ゲスト間の通信インターフェイスとして準仮想化シリアルドライバー (

virtio-serial) を使用する場合は、virtio-serialドライバーが Windows ゲストにインストールされていることを確認します。virtioドライバーのインストールの詳細は、Windows ゲストへの virtio ドライバーのインストール を参照してください。

検証

Windows 仮想マシンで、Services ウィンドウに移動します。

Computer Management > Services

-

QEMU Guest AgentのステータスがRunningであることを確認します。

2.4.3. QEMU ゲストエージェントを必要とする仮想化機能

仮想マシン (VM) で QEMU ゲストエージェント (GA) を有効にすると、ホスト上で次のコマンドを使用して仮想マシンを管理できます。

virsh shutdown --mode=agent-

このシャットダウン方法は、

virsh shutdown --mode=acpiよりも信頼性が高くなります。これは、QEMU GA で使用するvirsh shutdownは、確実にクリーンな状態で協調ゲストをシャットダウンするためです。

virsh domfsfreezeおよびvirsh domfsthaw- ゲストファイルシステムを分離してフリーズします。

virsh domfstrimゲストにファイルシステムをトリミングするように指示します。これにより、移行中に転送する必要のあるデータを削減できます。

重要このコマンドを使用して Linux 仮想マシンを管理する場合は、ゲストオペレーティングシステムで次の SELinux ブール値も設定する必要があります。

# setsebool virt_qemu_ga_read_nonsecurity_files onvirsh domtime- ゲストの時計をクエリーまたは設定します。

virsh setvcpus --guest- ゲストに CPU をオフラインにするように指示します。これは、CPU をホットアンプラグできない場合に便利です。

virsh domifaddr --source agent- QEMU GA を使用してゲストオペレーティングシステムの IP アドレスをクエリーします。たとえば、ゲストインターフェイスがホストインターフェイスに直接接続されている場合に便利です。

virsh domfsinfo- 実行中のゲストにマウントされているファイルシステムのリストを表示します。

virsh set-user-password- ゲストの特定のユーザーアカウントのパスワードを設定します。

virsh set-user-sshkeysゲストの特定のユーザーの認可された SSH 鍵ファイルを編集します。

重要このコマンドを使用して Linux 仮想マシンを管理する場合は、ゲストオペレーティングシステムで次の SELinux ブール値も設定する必要があります。

# setsebool virt_qemu_ga_manage_ssh on

第3章 仮想マシンの作成

RHEL 9 で仮想マシンを作成する場合は、コマンドライン または RHEL 9 Web コンソール を使用します。

3.1. コマンドラインを使用した仮想マシンの作成

コマンドラインを使用して RHEL 9 で仮想マシン (VM) を作成するには、virt-install ユーティリティーを使用します。

前提条件

- ホストシステムで仮想化が 有効 になっている。

- ディスク領域、RAM、CPU など、仮想マシンに割り当てるのに十分なシステムリソースがある。推奨される値は、仮想マシンで行うタスクやワークロードにより大きく異なる可能性がある。

オペレーティングシステム (OS) のインストールソースがローカルまたはネットワークで利用できる。これには、次のいずれかを使用できます。

- インストールメディアの ISO イメージ

既存の仮想マシンインストールのディスクイメージ

警告RHEL 9 では、ホストの CD-ROM デバイスまたは DVD-ROM デバイスからインストールすることができません。RHEL 9 で利用可能な仮想マシンのインストール方法を使用する際に、インストールソースに CD-ROM または DVD-ROM を選択するとインストールに失敗します。詳細は、Red Hat ナレッジベースソリューション RHEL 7 or higher can’t install guest OS from CD/DVD-ROM を参照してください。

また、Red Hat は、限られたゲストオペレーティングシステムのセット のみをサポートしていることにも注意してください。

- 任意: インストールをより速く、簡単に設定するために、キックスタートファイルを利用できます。

手順

仮想マシンを作成して OS のインストールを開始するには、以下の必須引数を指定して、virt-install コマンドを使用します。

-

--name: 新しいマシンの名前 -

--memory: 割り当てるメモリーの量 -

--vcpus: 割り当てる仮想 CPU の数 -

--disk: 割り当てるストレージのタイプとサイズ -

--cdromまたは--location: OS インストールソースのタイプと場所 --osinfo: インストールする OS の種類とバージョン注記--osinfo引数に使用可能なすべての値をリスト表示するには、virt-install --osinfo listコマンドを実行します。詳細は、

libosinfo-binパッケージをインストールして、osinfo-query osコマンドを実行します。

選択したインストール方法に応じて、必要なオプションと値が異なります。例は、以下のコマンドを参照してください。

次のコマンドでは、demo-guest1 という名前の仮想マシンを作成し、ローカルの /home/username/Downloads/Win10install.iso ファイルに保存されている ISO イメージから、Windows 10 OS をインストールします。この仮想マシンには、2048 MiB の RAM と 2 つの vCPU が割り当てられ、80 GiB の qcow2 仮想ディスクも自動的に割り当てられます。

# virt-install \ --name demo-guest1 --memory 2048 \ --vcpus 2 --disk size=80 --osinfo win10 \ --cdrom /home/username/Downloads/Win10install.iso次のコマンドは、demo-guest2 という名前の仮想マシンを作成し、/home/username/Downloads/rhel9.iso イメージを使用して、ライブ CD から RHEL 9 OS を実行します。この仮想マシンにはディスク領域が割り当てられないため、セッション中に行った変更は保持されません。また、仮想マシンには、4096 MiB の RAM と、4 つの vCPU が割り当てられます。

# virt-install \ --name demo-guest2 --memory 4096 --vcpus 4 \ --disk none --livecd --osinfo rhel9.0 \ --cdrom /home/username/Downloads/rhel9.iso次のコマンドは、demo-guest3 という名前の RHEL 9 仮想マシンを作成し、既存のディスクイメージ /home/username/backup/disk.qcow2 に接続します。これは、マシン間でハードドライブを物理的に移動するのと似ています。したがって、demo-guest3 で使用できる OS およびデータは、イメージが処理された方法により決定します。また、仮想マシンには、2048 MiB の RAM および 2 つの vCPU が割り当てられます。

# virt-install \ --name demo-guest3 --memory 2048 --vcpus 2 \ --os-info rhel9.0 --import \ --disk /home/username/backup/disk.qcow2次のコマンドは、demo-guest4 という名前の仮想マシンを作成し、URL

http://example.com/OS-installからインストールします。インストールを開始するには、作業中の OS インストールツリーを URL に指定する必要があります。さらに、OS は、キックスタートファイル /home/username/ks.cfg で自動的に設定されます。この仮想マシンには、2048 MiB の RAM、2 つの vCPU、および 160 GiB の qcow2 仮想ディスクも割り当てられます。# virt-install \ --name demo-guest4 --memory 2048 --vcpus 2 --disk size=160 \ --osinfo rhel9.0 --location http://example.com/OS-install \ --initrd-inject /home/username/ks.cfg --extra-args="inst.ks=file:/ks.cfg console=tty0 console=ttyS0,115200n8"さらに、ARM 64 ホスト上の RHEL 9 で demo-guest4 をホストする場合は、キックスタートファイルによって

kernel-64kパッケージが確実にインストールされるように、次の行を追加します。%packages -kernel kernel-64k %end次のコマンドは、demo-guest5 という名前の仮想マシンを作成し、グラフィックスがない、テキストのみのモードである

RHEL9.isoイメージファイルからインストールします。ゲストコンソールをシリアルコンソールに接続します。仮想マシンには、16384 MiB のメモリー、16 個の vCPU、および 280 GiB のディスクが割り当てられます。このようなインストールは、低速なネットワークリンクを介してホストに接続する際に便利です。# virt-install \ --name demo-guest5 --memory 16384 --vcpus 16 --disk size=280 \ --osinfo rhel9.0 --location RHEL9.iso \ --graphics none --extra-args='console=ttyS0'次のコマンドは、demo-guest6 という名前の仮想マシンを作成します。この仮想マシンの設定は demo-guest5 と同じですが、リモートホスト 192.0.2.1 に置かれます。

# virt-install \ --connect qemu+ssh://root@192.0.2.1/system --name demo-guest6 --memory 16384 \ --vcpus 16 --disk size=280 --osinfo rhel9.0 --location RHEL9.iso \ --graphics none --extra-args='console=ttyS0'次のコマンドは、demo-guest-7 という名前の仮想マシンを作成します。この仮想マシンの設定は demo-guest5 と同じですが、ストレージには IBM Z DASD 仲介デバイス

mdev_30820a6f_b1a5_4503_91ca_0c10ba12345a_0_0_29a8を使用し、デバイス番号1111を割り当てます。# virt-install \ --name demo-guest7 --memory 16384 --vcpus 16 --disk size=280 \ --osinfo rhel9.0 --location RHEL9.iso --graphics none \ --disk none --hostdev mdev_30820a6f_b1a5_4503_91ca_0c10ba12345a_0_0_29a8,address.type=ccw,address.cssid=0xfe,address.ssid=0x0,address.devno=0x1111,boot-order=1 \ --extra-args 'rd.dasd=0.0.1111'インストールに利用可能な仲介デバイスの名前は、

virsh nodedev-list --cap mdevコマンドを使用して取得できることに注意してください。次のコマンドは、demo-guest-8 という名前の仮想マシンを作成します。これは demo-guest5 と同じ設定ですが、ネットワーク用のホストデバイス

pci_0003_00_00_0を提供し、グラフィカルインストール用のグラフィックを設定します。# virt-install \ --name demo-guest8 --memory 16384 --vcpus 16 --disk size=280 \ --os-variant rhel9.0 --location RHEL9.iso --graphics vnc,listen=0.0.0.0,5901 \ --input keyboard,bus=virtio --input mouse,bus=virtio \ --hostdev pci_0003_00_00_0 --network none'インストールに使用できるホストデバイスの名前は、

virsh nodedev-list --cap pciコマンドを使用して取得できることに注意してください。インストール GUI を使用するには、インストールの開始時に VNC ポート 5901 で VNC ビューアーをホストの IP に接続できます。ただし、最初にファイアウォールでこのポートを開く必要がある場合があります。次に例を示します。# firewall-cmd --add-port 5901/tcp

検証

- 仮想マシンが問題なく作成されると、仮想マシンのグラフィカルコンソールで virt-viewer 画面が開き、ゲスト OS のインストールが開始します。

トラブルシューティング

virt-installがcannot find default networkエラーを出力する場合は、以下のようにします。libvirt-daemon-config-networkパッケージがインストールされていることを確認します。# {PackageManagerCommand} info libvirt-daemon-config-network Installed Packages Name : libvirt-daemon-config-network [...]libvirtのデフォルトネットワークがアクティブで、自動的に起動するように設定されていることを確認します。# virsh net-list --all Name State Autostart Persistent -------------------------------------------- default active yes yesそうでない場合は、デフォルトのネットワークをアクティブにし、自動起動に設定します。

# virsh net-autostart default Network default marked as autostarted # virsh net-start default Network default startedデフォルトのネットワークをアクティベートしても以下のエラーが出て失敗する場合は、

libvirt-daemon-config-networkパッケージが正常にインストールされていません。error: failed to get network 'default' error: Network not found: no network with matching name 'default'この問題を修正するには、以下のコマンドで

libvirt-daemon-config-networkを再インストールします。# {PackageManagerCommand} reinstall libvirt-daemon-config-network以下のようなエラーでデフォルトのネットワークをアクティベートできない場合には、デフォルトネットワークのサブネットとホストの既存インターフェイスで競合が発生しています。

error: Failed to start network default error: internal error: Network is already in use by interface ens2これを修正するには、

virsh net-edit defaultコマンドを使用して、設定の192.0.2.*の値を、ホストで使用していないサブネットに変更します。

3.2. Web コンソールを使用した仮想マシンの作成、およびゲストのオペレーティングシステムのインストール

RHEL 9 ホストの GUI で仮想マシンを管理するには、Web コンソールを使用します。次のセクションでは、RHEL 9 Web コンソールを使用して仮想マシンを作成し、仮想マシンにゲストオペレーティングシステムをインストールする方法を説明します。

3.2.1. Web コンソールを使用した仮想マシンの作成

RHEL 9 Web コンソールが接続しているホストマシン上に仮想マシン (VM) を作成するには、以下の手順を使用します。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- ホストシステムで仮想化が有効になっている。

- Web コンソールの仮想マシンプラグインがホストシステムにインストールされている。

- ディスク領域、RAM、CPU など、仮想マシンに割り当てるのに十分なシステムリソースがある。推奨される値は、仮想マシンで行うタスクやワークロードにより大きく異なる可能性がある。

手順

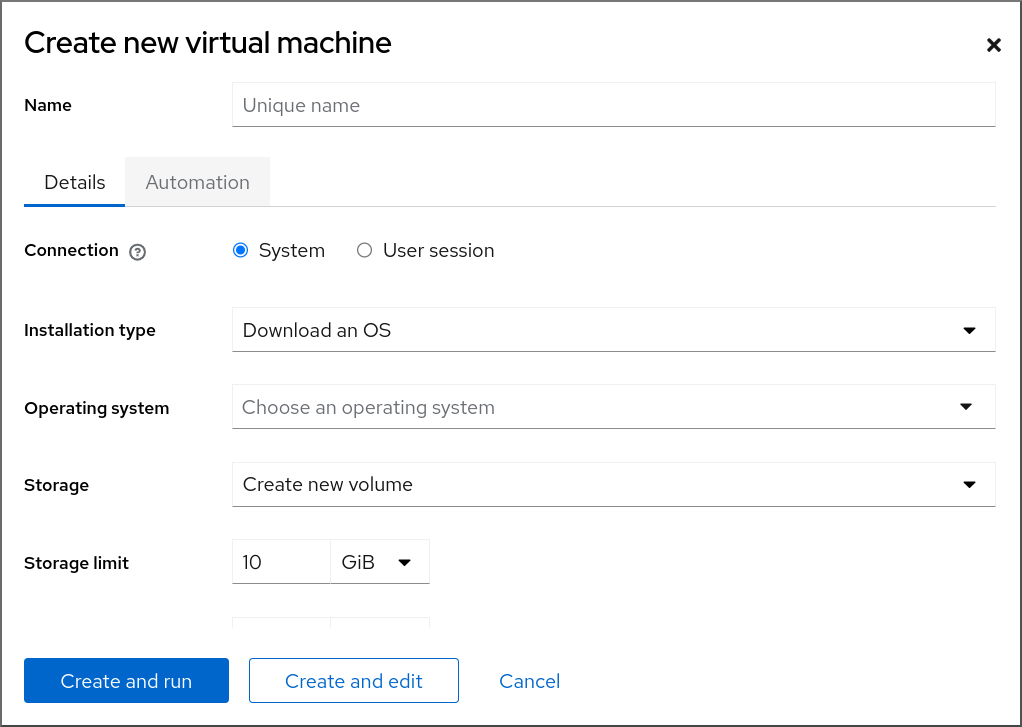

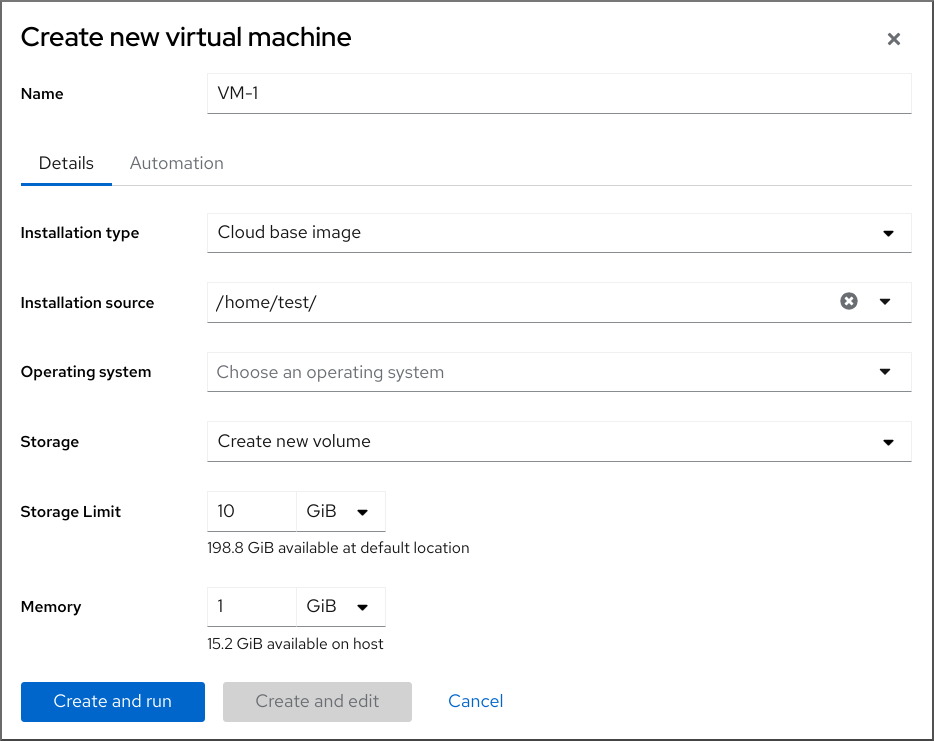

Web コンソールの Virtual Machines インターフェイスで、 をクリックします。

Create new virtual machine ダイアログが表示されます。

作成する仮想マシンの基本設定を入力します。

- 名前 - 仮想マシンの名前

- 接続 - セッションに付与される権限のレベル。詳細は、Web コンソールで関連するダイアログボックスをデプロイメントしてください。

- インストールタイプ - インストールでは、ローカルのインストールメディア、URL、PXE ネットワークブート、クラウドベースイメージを使用したり、または限定されたオペレーティングシステムのセットからオペレーティングシステムをダウンロードしたりできます。

Operating system - 仮想マシン上で実行されているゲストオペレーティングシステム。Red Hat がサポートするのは、限られたゲストオペレーティングシステムのセット のみです。

注記Web コンソールから Red Hat Enterprise Linux を直接ダウンロードしてインストールする場合は、Offline token フィールドにオフライントークンを追加する必要があります。

- Storage - ストレージのタイプ。

- Storage Limit - ストレージ領域の容量。

- Memory - メモリーの容量。

仮想マシンを作成します。

- 仮想マシンでオペレーティングシステムを自動的にインストールする場合は、 をクリックします。

- オペレーティングシステムをインストールする前に仮想マシンを編集する場合は、 をクリックします。

3.2.2. Web コンソールでディスクイメージをインポートして仮想マシンを作成する手順

RHEL 9 Web コンソールで既存の仮想マシンインストールのディスクイメージをインポートすることで、仮想マシン (VM) を作成できます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインがシステムにインストールされている。

- ディスク領域、RAM、CPU など、仮想マシンに割り当てるのに十分なシステムリソースがある。推奨値は、仮想マシンで行うタスクやワークロードにより大きく異なる可能性があります。

- 既存の仮想マシンインストールのディスクイメージがダウンロードされている。

手順

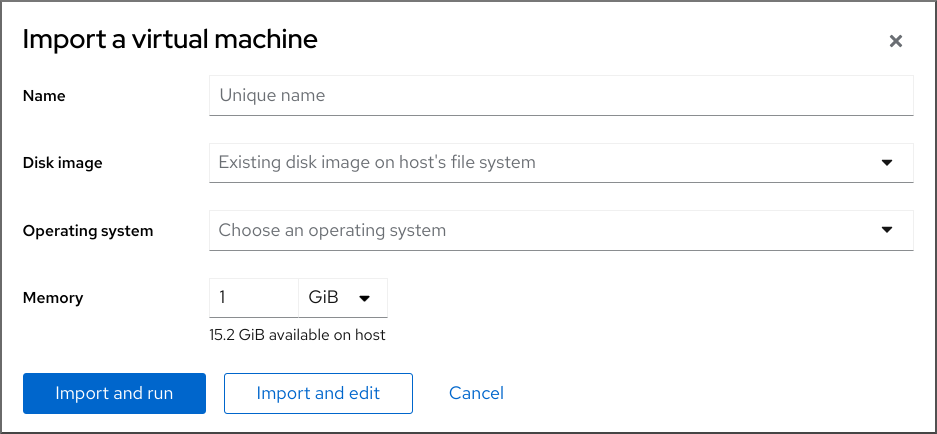

Web コンソールの Virtual Machines インターフェイスで、 をクリックします。

Import a virtual machine ダイアログが表示されます。

作成する仮想マシンの基本設定を入力します。

- 名前 - 仮想マシンの名前

- ディスクイメージ - ホストシステム上の仮想マシンに存在するディスクイメージのパスです。

- Operating system - 仮想マシンディスク上で実行されているオペレーティングシステム。Red Hat がサポートするのは、限られたゲストオペレーティングシステムのセット のみです。

- Memory - 仮想マシンによる使用のために割り当てるメモリーの容量。

仮想マシンをインポートします。

- 仮想マシン設定をさらに編集せずに仮想マシンにオペレーティングシステムをインストールするには、 をクリックします。

- オペレーティングシステムのインストール前に仮想マシン設定を編集するには、 をクリックします。

3.2.3. Web コンソールを使用したゲストのオペレーティングシステムのインストール

仮想マシンを初めて起動するときは、仮想マシンにオペレーティングシステムをインストールする必要があります。

新しい仮想マシンを作成するときに または をクリックすると、仮想マシン作成時にオペレーティングシステムのインストールルーチンが自動的に開始されます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインがホストシステムにインストールされている。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

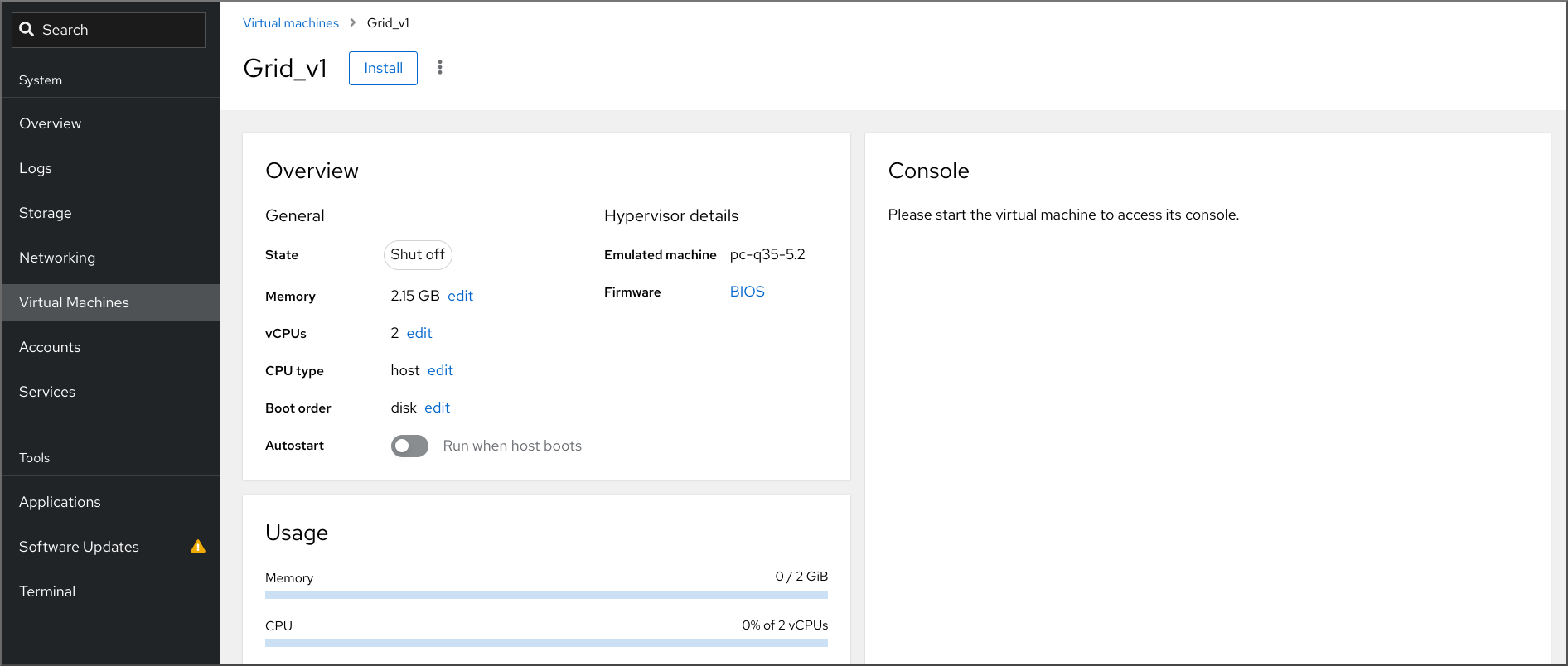

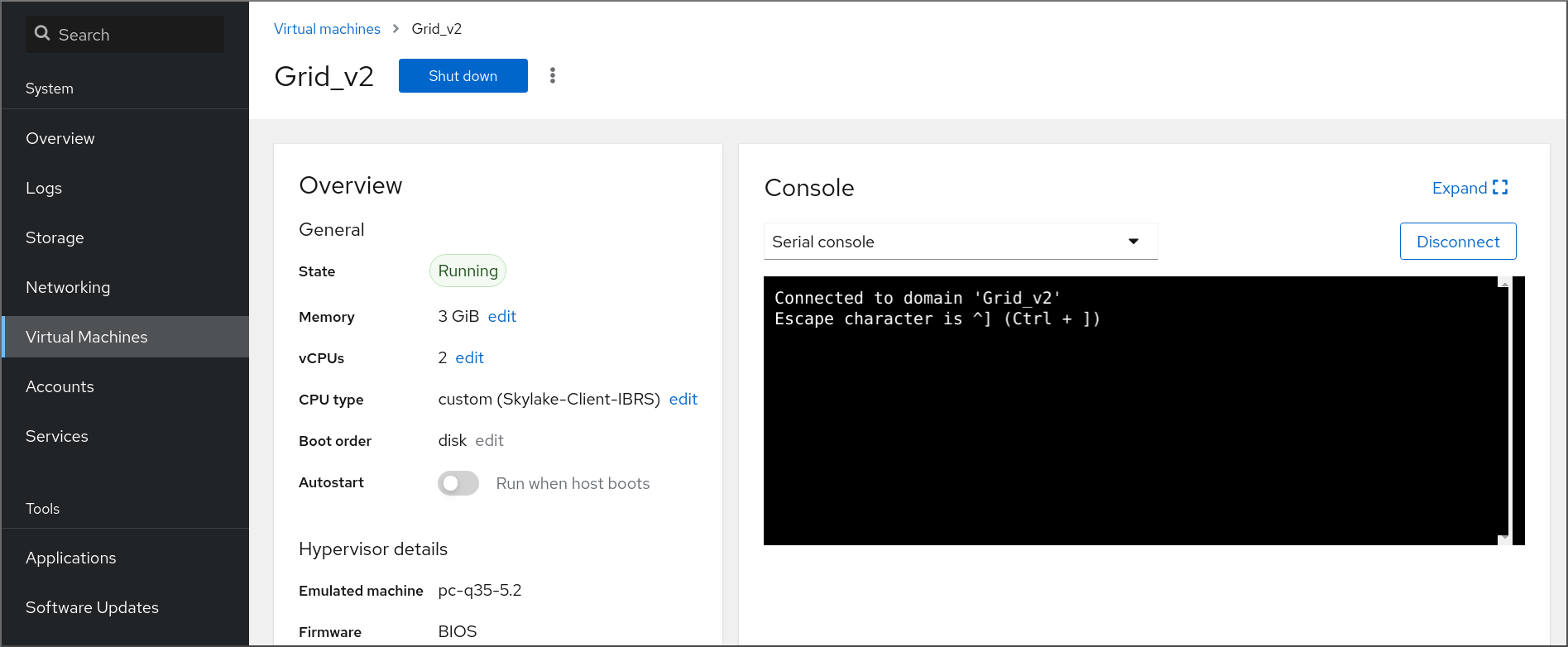

Virtual Machines インターフェイスで、ゲスト OS をインストールする仮想マシンをクリックします。

選択した仮想マシンの基本情報を含む新しいページが開き、仮想マシンのさまざまな側面を管理するための制御を行います。

オプション: ファームウェアを変更します。

注記新しい仮想マシンの作成時に または を選択し、かつ仮想マシンに OS がまだインストールされていない場合にのみ、ファームウェアを変更できます。

+ ..ファームウェアをクリックします。

- Change Firmware ウィンドウで、必要なファームウェアを選択します。

- をクリックします。

をクリックします。

仮想マシンコンソールで、オペレーティングシステムのインストールルーチンが実行します。

トラブルシューティング

- インストールルーチンが失敗した場合は、インストールを再度開始する前に、仮想マシンを削除して再作成します。

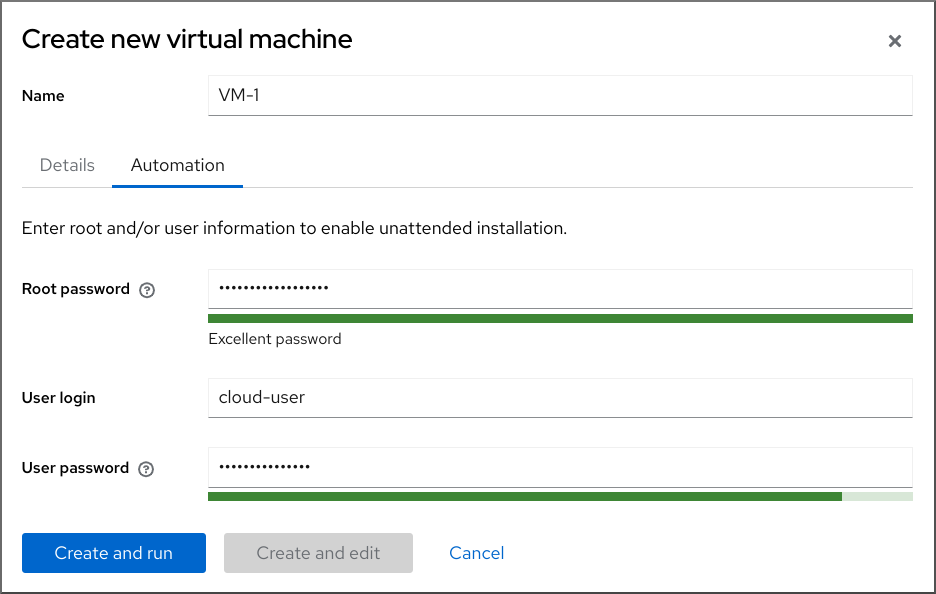

3.2.4. Web コンソールを使用したクラウドイメージ認証による仮想マシンの作成

デフォルトでは、ディストリビューションクラウドイメージにはログインアカウントがありません。ただし、RHEL Web コンソールを使用して、仮想マシンを作成し、root アカウントとユーザーアカウントのログイン認証情報を指定して、cloud-init に渡すことができるようになりました。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

- ホストシステムで仮想化が 有効 になっている。

- ディスク領域、RAM、CPU など、仮想マシンに割り当てるのに十分なシステムリソースがある。推奨される値は、仮想マシンで行うタスクやワークロードにより大きく異なる可能性があります。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

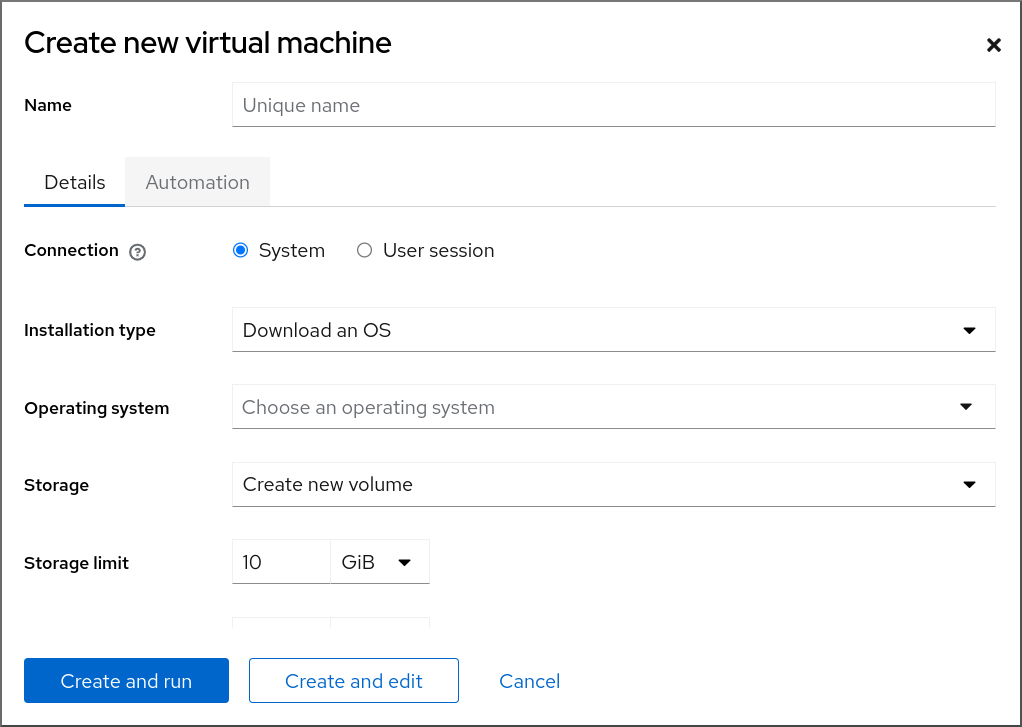

Web コンソールの インターフェイスで、 をクリックします。

仮想マシンの新規作成ダイアログが表示されます。

- 名前 フィールドに、仮想マシンの名前を入力します。

Details タブの Installation type フィールドで、Cloud base image を選択します。

- インストールソース フィールドで、ホストシステム上のイメージファイルへのパスを設定します。

作成する仮想マシンの設定を入力します。

- オペレーティングシステム - 仮想マシンのオペレーティングシステム。Red Hat がサポートするのは、限られたゲストオペレーティングシステムのセット のみです。

- ストレージ - 仮想マシンを設定するストレージの種類

- ストレージのサイズ - 仮想マシンを設定するストレージ容量

- メモリー - 仮想マシンを設定するメモリーのサイズ

Automation タブをクリックします。

クラウド認証の認証情報を設定します。

- root パスワード - 仮想マシンの root パスワードを入力します。root パスワードを設定しない場合は、フィールドを空白のままにします。

- ユーザーログイン - cloud-init ユーザーログインを入力します。ユーザーアカウントを作成しない場合は、このフィールドを空白のままにします。

ユーザーパスワード - パスワードを入力します。ユーザーアカウントを作成しない場合は、このフィールドを空白のままにします。

をクリックします。

仮想マシンが作成されます。

第4章 仮想マシンの起動

RHEL 9 で仮想マシン (VM) を起動する場合は、コマンドライン または Web コンソール GUI を使用できます。

前提条件

- 仮想マシンを起動する前に仮想マシンを作成しておく。理想としては、OS をインストールしておく。手順は、仮想マシンの作成 を参照してください。

4.1. コマンドラインを使用した仮想マシンの起動

コマンドライン (CLI) を使用して、シャットダウンした仮想マシン (VM) を起動したり、保存した仮想マシンを復元したりできます。CLI を使用すると、ローカル仮想マシンとリモート仮想マシンの両方を起動できます。

前提条件

- すでに定義されている非アクティブな仮想マシン

- 仮想マシンの名前

リモート仮想マシンの場合は、以下も設定されている。

- 仮想マシンが置かれているホストの IP アドレス

- ホストへの root アクセス権限

手順

ローカルの仮想マシンには、

virsh startユーティリティーを使用します。たとえば、次のコマンドは仮想マシン demo-guest1 を起動します。

# virsh start demo-guest1 Domain 'demo-guest1' startedリモートホストにある仮想マシンでは、ホストへの QEMU+SSH 接続と共に

virsh startユーティリティーを使用します。たとえば、次のコマンドは、ホスト 192.0.2.1 にある仮想マシン demo-guest1 を起動します。

# virsh -c qemu+ssh://root@192.0.2.1/system start demo-guest1 root@192.0.2.1's password: Domain 'demo-guest1' started

4.2. Web コンソールを使用した仮想マシンの起動

仮想マシンが 停止 状態にある場合は、RHEL 9 Web コンソールを使用して起動できます。ホストの起動時に、仮想マシンが自動的に起動するように設定することもできます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

- すでに定義されている非アクティブな仮想マシン

- 仮想マシンの名前

手順

インターフェイスで、起動する仮想マシンをクリックします。

選択した仮想マシンの詳細情報を含む新しいページが開き、仮想マシンのシャットダウンおよび削除を制御できます。

をクリックします。

仮想マシンが起動し、コンソールまたはグラフィカル出力に接続 できます。

オプション: ホスト起動時に仮想マシンが自動的に起動するように設定するには、Overview セクションの

Autostartチェックボックスを切り替えます。libvirt が管理していないネットワークインターフェイスを使用する場合は、systemd 設定も変更する必要があります。そうしないと、影響を受ける仮想マシンが起動できなくなる可能性があります。starting virtual machines automatically when the host starts を参照してください。

4.3. ホストの起動時に仮想マシンを自動的に起動する

実行中の仮想マシン (VM) のホストが再起動すると、仮想マシンはシャットダウンされるため、デフォルトで手動で再起動する必要があります。ホストの実行中に仮想マシンがアクティブであることを確認するには、仮想マシンが自動的に起動するように設定できます。

前提条件

手順

virsh autostartユーティリティーを使用して、ホストの起動時に仮想マシンが自動的に起動するように設定します。たとえば、次のコマンドは、demo-guest1 仮想マシンを自動的に起動するように設定します。

# virsh autostart demo-guest1 Domain 'demo-guest1' marked as autostartedlibvirtが管理していないネットワークインターフェイスを使用する場合は、systemd 設定にも追加の変更を行う必要があります。これを行わないと、影響を受ける仮想マシンの起動に失敗する可能性があります。注記このようなインターフェイスには、以下の例が含まれます。

-

NetworkManagerが作成したブリッジデバイス -

<forward mode='bridge'/>を使用するように設定されたネットワーク

systemd 設定ディレクトリーツリーに、

virtqemud.service.dディレクトリーが存在しない場合は作成します。# mkdir -p /etc/systemd/system/virtqemud.service.d/以前に作成したディレクトリーに、

10-network-online.confsystemd ユニットオーバーライドファイルを作成します。このファイルのコンテンツは、virtqemudサービスのデフォルトの systemd 設定を上書きします。# touch /etc/systemd/system/virtqemud.service.d/10-network-online.conf10-network-online.confファイルに以下の行を追加します。この設定変更により、ホストのネットワークの準備ができてから、systemd がvirtqemudサービスを起動するようになります。[Unit] After=network-online.target

-

検証

仮想マシンの設定を表示し、自動開始 オプションが有効になっていることを確認します。

たとえば、次のコマンドは、自動開始 オプションなど、demo-guest1 仮想マシンの基本情報を表示します。

# virsh dominfo demo-guest1 Id: 2 Name: demo-guest1 UUID: e46bc81c-74e2-406e-bd7a-67042bae80d1 OS Type: hvm State: running CPU(s): 2 CPU time: 385.9s Max memory: 4194304 KiB Used memory: 4194304 KiB Persistent: yes Autostart: enable Managed save: no Security model: selinux Security DOI: 0 Security label: system_u:system_r:svirt_t:s0:c873,c919 (enforcing)libvirt が管理していないネットワークインターフェイスを使用する場合は、

10-network-online.confファイルの内容が次の出力と一致するかどうかを確認してください。$ cat /etc/systemd/system/virtqemud.service.d/10-network-online.conf [Unit] After=network-online.target

第5章 仮想マシンへの接続

RHEL 9 で仮想マシンと相互作用するには、以下のいずれかの方法で接続する必要があります。

- Web コンソールインターフェイスを使用する場合は、Web コンソールインターフェイスの仮想マシンペインを使用します。詳細は、Web コンソールを使用した仮想マシンとの相互作用 を参照してください。

- Web コンソールを使用せずに、仮想マシンのグラフィカル表示と相互作用する必要がある場合は、Virt Viewer アプリケーションを使用します。詳細は、Virt Viewer で仮想マシンのグラフィカルコンソールを開く方法 を参照してください。

- グラフィック表示ができない、または必要ない場合は、SSH の端末接続 を使用します。

- ネットワークを使用してシステムから仮想マシンに到達できない場合は、virsh コンソール を使用します。

接続先の仮想マシンがローカルホストではなくリモートホストにある場合は、リモートホストにより便利にアクセスできるように、システムを設定することもできます。

5.1. Web コンソールを使用した仮想マシンとの相互作用

RHEL 9 Web コンソールで仮想マシンと相互作用するには、仮想マシンのコンソールに接続する必要があります。グラフィカルコンソールおよびシリアルコンソールの両方が含まれます。

- Web コンソールで仮想マシンのグラフィカルインターフェイスを操作するには、グラフィカルコンソール を使用します。

- リモートビューアーで仮想マシンのグラフィカルインターフェイスを操作する場合は、リモートビューアーでグラフィカルコンソールの表示 を参照してください。

- Web コンソールで仮想マシンの CLI を操作するには、シリアルコンソール を使用します。

5.1.1. Web コンソールで仮想マシンのグラフィカルコンソールの表示

仮想マシンのコンソールインターフェイスを使用すると、RHEL 9 Web コンソールに、選択した仮想マシンのグラフィカル出力を表示できます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

- ホストおよび仮想マシンの両方が、グラフィカルインターフェイスに対応している。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

インターフェイスで、グラフィカルコンソールを表示する仮想マシンをクリックします。

仮想マシンの概要とコンソールセクションがある新しいページが開きます。

コンソールドロップダウンメニューで を選択します。

Web インターフェイスのメニューの下に VNC コンソールが表示されます。

グラフィカルコンソールが Web インターフェイスに表示されます。

をクリックします。

実際のマシンの場合と同じように、マウスとキーボードを使用して仮想マシンのコンソールと相互作用できるようになりました。仮想マシンコンソールには、仮想マシンで実行しているアクティビティーが表示されます。

Web コンソールを実行しているホストで、特定の鍵の組み合わせ (Ctrl+Alt+Del など) を傍受して、仮想マシンに送信しないようにできます。

このようなキーの組み合わせを送信する場合は、 メニューをクリックして、送信するキーシーケンスを選択します。

たとえば、仮想マシンに Ctrl+Alt+Del の組み合わせを送信するには、 メニューをクリックして、 メニューエントリーを選択します。

トラブルシューティング

- グラフィカルコンソールをクリックしても効果がない場合は、コンソールを全画面表示にします。これは、マウスカーソルオフセットの既知の問題です。

5.1.2. Web コンソールを使用して、リモートビューアーでグラフィカルコンソールを表示する方法

Web コンソールインターフェイスを使用して、選択した仮想マシンのグラフィカルコンソールを Virt Viewer などのリモートビューアーに表示することができます。

Web コンソールから Virt Viewer を起動できます。他の VNC リモートビューアーは手動で起動できます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

- ホストおよび仮想マシンの両方が、グラフィカルインターフェイスに対応している。

Virt Viewer でグラフィカルコンソールを表示する前に、Web コンソールが接続しているマシンに Virt Viewer をインストールする必要があります。

をクリックします。

virt ビューアー (

.vv) ファイルをダウンロードします。- ファイルを開き、Virt Viewer を起動します。

リモートビューアーは、ほとんどのオペレーティングシステムで使用できます。ブラウザーの拡張機能やプラグインによっては、Web コンソールで Virt Viewer を開けないことがあります。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

インターフェイスで、グラフィカルコンソールを表示する仮想マシンをクリックします。

仮想マシンの概要とコンソールセクションがある新しいページが開きます。

コンソールドロップダウンメニューで を選択します。

をクリックします。

Virt Viewer でグラフィカルコンソールが開きます。

実際のマシンの場合と同じように、マウスとキーボードを使用して仮想マシンのコンソールと相互作用できます。仮想マシンコンソールには、仮想マシンで実行しているアクティビティーが表示されます。

Web コンソールを実行しているサーバーで、特定の鍵の組み合わせ (Ctrl+Alt+Del など) を傍受して、仮想マシンに送信しないようにできます。

このようなキーの組み合わせを送信する場合は、 メニューをクリックして、送信するキーシーケンスを選択します。

たとえば、仮想マシンに Ctrl+Alt+F1 の組み合わせを送信するには、 メニューをクリックして、 メニューエントリーを選択します。

トラブルシューティング

- グラフィカルコンソールをクリックしても効果がない場合は、コンソールを全画面表示にします。これは、マウスカーソルオフセットの既知の問題です。

Web コンソールでリモートビューアーを起動することができない場合、または最適ではない場合は、以下のプロトコルを使用して、任意のビューアーアプリケーションに手動で接続できます。

-

アドレス - デフォルトのアドレスーは

127.0.0.1です。/etc/libvirt/qemu.confのvnc_listenパラメーターを変更して、ホストの IP アドレスに変更できます。 - VNC ポート - 5901

-

アドレス - デフォルトのアドレスーは

5.1.3. Web コンソールで仮想マシンのシリアルコンソールの表示

RHEL 9 Web コンソールで、選択した仮想マシンのシリアルコンソールを表示できます。これは、グラフィカルインターフェイスでホストマシンまたは仮想マシンを設定していない場合に便利です。

シリアルコンソールの詳細は、Opening a virtual machine serial console を参照してください。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

ペインで、シリアルコンソールを表示する仮想マシンをクリックします。

仮想マシンの概要とコンソールセクションがある新しいページが開きます。

コンソールドロップダウンメニューで を選択します。

グラフィカルコンソールが Web インターフェイスに表示されます。

仮想マシンからシリアルコンソールへの接続を切断して、再接続できます。

- 仮想マシンからシリアルコンソールへの接続を切断するには、 をクリックします。

- シリアルコンソールを仮想マシンに再接続するには、 をクリックします。

5.1.4. Web コンソールで SPICE リモートディスプレイプロトコルを VNC に置き換える

RHEL 9 ホストでは、SPICE リモートディスプレイプロトコルのサポートが削除されました。SPICE プロトコルを使用するように設定された仮想マシン (VM) がある場合は、Web コンソールを使用して SPICE プロトコルを VNC プロトコルに置き換えることができます。そうしないと、仮想マシンが起動に失敗します。

ただし、オーディオや USB パススルーなどの一部の SPICE デバイスは、VNC プロトコルに適切な代替機能が存在しないため、仮想マシンから削除されます。詳細は、RHEL 9 の採用における考慮事項 を参照してください。

デフォルトでは、RHEL 8 仮想マシンは SPICE プロトコルを使用するように設定されています。RHEL 9 ホストで、SPICE から VNC に切り替えないと、これらの仮想マシンは起動に失敗します。

前提条件

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

- SPICE リモートディスプレイプロトコルを使用するように設定され、すでにシャットダウンされている既存の仮想マシンがある。

手順

Web コンソールの仮想マシンインターフェイスで、SPICE プロトコルを使用するように設定されている仮想マシンのメニューボタン をクリックします。

さまざまな仮想マシン操作を制御するためのドロップダウンメニューが開きます。

をクリックします。

Replace SPICE devices ダイアログが開きます。

注記SPICE プロトコルを使用する既存の仮想マシンが複数ある場合は、このダイアログにそれらがリストされます。このダイアログで、1 つのステップで SPICE から VNC の使用に切り替える仮想マシンを複数選択できます。

をクリックします。

操作が成功したことを確認するメッセージが表示されます。

検証

- ボタンをクリックして、仮想マシンを起動します。

仮想マシンの概要インターフェイスを開きます。

VNC コンソールオプションがインターフェイスの コンソール ペインに表示されると、変換は成功しています。

5.2. Virt Viewer で仮想マシンのグラフィカルコンソールを開く方法

KVM 仮想マシンのグラフィカルコンソールに接続して、Virt Viewer デスクトップアプリケーションで開く場合は、以下の手順を行います。

前提条件

- システム、および接続している仮想マシンが、グラフィカルディスプレイに対応している。

- ターゲットの仮想マシンがリモートホストにある場合は、そのホストへの接続およびルートアクセス権限が確保されている。

- オプション: ターゲット仮想マシンがリモートホストにある場合は、リモートホストにアクセスしやすくなる ように libvirt と SSH を設定した。

手順

ローカルの仮想マシンに接続するには、次のコマンドを使用して、guest-name を、接続する仮想マシンの名前に置き換えます。

# virt-viewer guest-nameリモートの仮想マシンに接続するには、SSH プロトコルで

virt-viewerコマンドを実行します。たとえば、次のコマンドは、root 権限で、リモートシステム 192.0.2.1 にある guest-name という名前の仮想マシンに接続します。接続には、192.0.2.1 用の root 認証も必要になります。# virt-viewer --direct --connect qemu+ssh://root@192.0.2.1/system guest-name root@192.0.2.1's password:

検証

接続が正しく機能している場合は、Virt Viewer 画面に仮想マシンのディスプレイが表示されます。

実際のマシンの場合と同じように、マウスとキーボードを使用して仮想マシンのコンソールと相互作用できます。仮想マシンコンソールには、仮想マシンで実行しているアクティビティーが表示されます。

トラブルシューティング

- グラフィカルコンソールをクリックしても効果がない場合は、コンソールを全画面表示にします。これは、マウスカーソルオフセットの既知の問題です。

5.3. SSH を使用した仮想マシンへの接続

SSH 接続プロトコルを使用して仮想マシンの端末と相互作用するには、以下の手順に従います。

前提条件

- ターゲットの仮想マシンへのネットワーク接続および root アクセス権がある。

- ターゲットの仮想マシンがリモートホストにある場合は、そのホストへの接続およびルートのアクセス権限もある。

仮想マシンネットワークは、

libvirtが生成したdnsmasqにより IP アドレスを割り当てます。これは、たとえば、libvirtNAT ネットワーク などに該当します。特に、仮想マシンが次のネットワーク設定のいずれかを使用している場合、SSH を使用して仮想マシンに接続することはできません。

-

hostdevインターフェイス - ダイレクトインターフェイス

- ブリッジインターフェイス

-

libvirt-nssコンポーネントを仮想マシンのホストにインストールして有効にしている。そうでない場合は、以下を行います。libvirt-nssパッケージをインストールします。# dnf install libvirt-nss/etc/nsswitch.confファイルを編集し、libvirt_guestをhosts行に追加します。... passwd: compat shadow: compat group: compat hosts: files libvirt_guest dns ...

手順

リモート仮想マシンに接続する場合は、最初に SSH でその物理ホストに接続します。以下の例は、root 認証情報を使用してホストマシン

192.0.2.1に接続する方法を示しています。# ssh root@192.0.2.1 root@192.0.2.1's password: Last login: Mon Sep 24 12:05:36 2021 root~#仮想マシンの名前とユーザーアクセスの認証情報を使用して、仮想マシンに接続します。たとえば、以下は、root 認証情報を使用して、仮想マシン

testguest1に接続します。# ssh root@testguest1 root@testguest1's password: Last login: Wed Sep 12 12:05:36 2018 root~]#

トラブルシューティング

仮想マシンの名前が分からない場合は、

virsh list --allコマンドを使用すると、ホストで利用可能な仮想マシンのリストを表示できます。# virsh list --all Id Name State ---------------------------------------------------- 2 testguest1 running - testguest2 shut off

5.4. 仮想マシンのシリアルコンソールを開く

virsh console コマンドを使用すると、仮想マシンのシリアルコンソールに接続できます。

これは、仮想マシンが次のような場合に役に立ちます。

- VNC プロトコルは提供されないため、GUI ツールのビデオ表示には対応していません。

- ネットワークに接続されていないため、SSH を使用して 相互作用できない

前提条件

ホスト上の GRUB ブートローダーは、シリアルコンソールを使用するように設定する必要があります。確認するには、ホスト上の

/etc/default/grubファイルにGRUB_TERMINAL=serialパラメーターが含まれていることを確認します。$ sudo grep GRUB_TERMINAL /etc/default/grub GRUB_TERMINAL=serial仮想マシンには、

console type='pty'などのシリアルコンソールデバイスが設定されている必要がある。確認するには、以下の手順を実施します。# virsh dumpxml vm-name | grep console <console type='pty' tty='/dev/pts/2'> </console>仮想マシンに、カーネルコマンドラインでシリアルコンソールが設定されている。これを確認するには、仮想マシン上の

cat /proc/cmdlineコマンド出力に console=<console-name> が含まれている必要があります。<console-name> はアーキテクチャー固有です。-

AMD64 および Intel 64 の場合:

ttyS0 ARM 64 の場合:

ttyAMA0注記この手順の次のコマンドは

ttyS0を使用します。# cat /proc/cmdline BOOT_IMAGE=/vmlinuz-3.10.0-948.el7.x86_64 root=/dev/mapper/rhel-root ro console=tty0 console=ttyS0,9600n8 rd.lvm.lv=rhel/root rd.lvm.lv=rhel/swap rhgbシリアルコンソールが仮想マシンに正しく設定されていない場合は、virsh コンソール を仮想マシンに接続すると、応答のないゲストコンソールに接続できます。ただし、Ctrl+] ショートカットを使用して、応答しないコンソールを終了することができます。

仮想マシンでシリアルコンソールを設定するには、以下を行います。

仮想マシンで、

console=ttyS0カーネルオプションを有効にします。# grubby --update-kernel=ALL --args="console=ttyS0"変更を反映させない可能性があるカーネルオプションをクリアします。

# grub2-editenv - unset kernelopts- 仮想マシンを再起動します。

-

AMD64 および Intel 64 の場合:

serial-getty@<console-name>サービスを有効にする必要があります。たとえば、AMD64 および Intel 64 の場合:# systemctl status serial-getty@ttyS0.service ○ serial-getty@ttyS0.service - Serial Getty on ttyS0 Loaded: loaded (/usr/lib/systemd/system/serial-getty@.service; enabled; preset: enabled)

手順

ホストシステムで、

virsh consoleコマンドを使用します。次の例では、libvirt ドライバーが安全なコンソール処理に対応していると、仮想マシン guest1 に接続します。# virsh console guest1 --safe Connected to domain 'guest1' Escape character is ^] Subscription-name Kernel 3.10.0-948.el7.x86_64 on an x86_64 localhost login:- virsh コンソールは、標準のコマンドラインインターフェイスと同じ方法で相互作用できます。

5.5. リモートの仮想化ホストへのアクセスを容易にするための設定

libvirt ユーティリティーを使用してリモートホストシステムの仮想マシンを管理する場合は、-c qemu+ssh://root@hostname/system 構文を使用することが推奨されます。たとえば、ホスト 192.0.2.1 で、root で virsh list コマンドを実行します。

# virsh -c qemu+ssh://root@192.0.2.1/system list

root@192.0.2.1's password:

Id Name State

---------------------------------

1 remote-guest runningただし、SSH および libvirt の設定を変更すれば、接続の詳細を完全に指定する必要がなくなります。以下に例を示します。

# virsh -c remote-host list

root@192.0.2.1's password:

Id Name State

---------------------------------

1 remote-guest runningこの改善機能を有効にするには、以下の手順を行います。

手順

~/.ssh/configファイルを以下のように編集します。ここで、host-alias は特定のリモートホストに関連付けられた短縮名および root@192.0.2.1 のエイリアス、hosturl は host の URL アドレスです。# vi ~/.ssh/config Host example-host-alias User root Hostname 192.0.2.1/etc/libvirt/libvirt.confファイルを以下のように編集します。example-qemu-host-alias は、QEMU および libvirt ユーティリティーがqemu+ssh://192.0.2.1/systemに目的のホスト example-host-alias を関連付けるホストエイリアスです。# vi /etc/libvirt/libvirt.conf uri_aliases = [ "example-qemu-host-alias=qemu+ssh://example-host-alias/system", ]

検証

ローカルシステムで libvirt ベースのユーティリティーを使用し、

-c qemu-host-aliasパラメーターを追加することで、リモートの仮想マシンを管理できることを確認します。これにより、リモートホストの SSH でコマンドが自動的に実行されます。たとえば、以下のコマンドにより、前の手順で example-qemu-host-alias としてセットアップした接続である、192.0.2.1 リモートホスト上の仮想マシンがリスト表示されることを確認します。

# virsh -c example-qemu-host-alias list root@192.0.2.1's password: Id Name State ---------------------------------------- 1 example-remote-guest running注記virshの他に、-c(または--connect) オプションと、上記のリモートホストアクセス設定は、以下のユーティリティーで使用できます。

次のステップ

libvirt ユーティリティーを、1 台のリモートホストで排他的に使用する場合は、libvirt ベースのユーティリティーのデフォルトターゲットとして特定の接続を設定することもできます。ただし、ローカルホストまたは別のリモートホストでも仮想マシンを管理する場合、この方法は推奨されません。

/etc/libvirt/libvirt.confファイルを編集して、uri_defaultパラメーターの値を、デフォルトの libvirt ターゲットとして example-qemu-host-alias に設定できます。# These can be used in cases when no URI is supplied by the application # (@uri_default also prevents probing of the hypervisor driver). # uri_default = "example-qemu-host-alias"これにより、指定したリモートホストで、libvirt ベースのコマンドがすべて自動的に実行されます。

$ virsh list root@192.0.2.1's password: Id Name State --------------------------------- 1 example-remote-guest runningリモートホストに接続する場合、リモートシステムへの root パスワードの入力を回避できます。そのためには、以下の方法を 1 つ以上行います。

- リモートホストへのキーベースの SSH アクセスを設定する

- SSH 接続の多重化を使用してリモートシステムに接続する **Web UI で IdM にログイン:Kerberos チケットの使用

-

-c(または--connect) オプションを使用して、virt-install、

virt-viewer、および virsh コマンドをリモートホストで実行できます。

5.6. コマンドラインを使用した SPICE リモートディスプレイプロトコルの VNC の置き換え

RHEL 9 ホストでは、SPICE リモートディスプレイプロトコルのサポートが削除されました。SPICE プロトコルを使用するように設定されている仮想マシン(VM)がある場合は、コマンドラインを使用して SPICE プロトコルを VNC プロトコルに置き換えることができます。そうしないと、仮想マシンが起動に失敗します。

ただし、オーディオや USB パススルーなどの一部の SPICE デバイスは、VNC プロトコルに適切な代替機能が存在しないため、仮想マシンから削除されます。詳細は、RHEL 9 の採用における考慮事項 を参照してください。

デフォルトでは、RHEL 8 仮想マシンは SPICE プロトコルを使用するように設定されています。RHEL 9 ホストで、SPICE から VNC に切り替えないと、これらの仮想マシンは起動に失敗します。

前提条件

- SPICE リモートディスプレイプロトコルを使用するように設定され、すでにシャットダウンされている既存の仮想マシンがある。

手順

ホストで次のコマンドを実行して、'<vm-name>' を VNC に変換する仮想マシンの名前に置き換えます。

# virt-xml <vm-name> --edit --convert-to-vnc Domain 'vm-name' defined successfully

検証

変換した仮想マシンの設定を検査し、グラフィックタイプが

vncとして表示されていることを確認します。# virsh dumpxml -xml <vm-name> | grep "graphics" <graphics type='vnc' port='5900' autoport='yes' listen='127.0.0.1'>

5.7. VNC パスワードの設定

仮想マシン (VM) のグラフィカル出力へのアクセスを管理するには、仮想マシンの VNC コンソールのパスワードを設定できます。

仮想マシンに VNC パスワードが設定されている場合、仮想マシンのユーザーは、たとえば virt-viewer ユーティリティーを使用して仮想マシンの VNC グラフィカルコンソールを表示したり操作したりするときに、パスワードを入力する必要があります。

VNC パスワードは、仮想マシン環境のセキュリティーを確保するのに十分な手段ではありません。詳細は、VNC セキュリティーに関する QEMU のドキュメント を参照してください。

また、VNC パスワードは、仮想マシンの設定にプレーンテキストで保存されます。そのため、パスワードを有効にする場合は、ユーザーが仮想マシン設定を表示できないようにする必要があります。

前提条件

VNC パスワードで保護する仮想マシンに VNC グラフィックスが設定されている。

これが当てはまるかどうかを確認するには、次のように

virsh dumpxmlコマンドを使用します。# virsh dumpxml <vm-name> | grep graphics <graphics type='vnc' ports='-1' autoport=yes listen=127.0.0.1> </graphics>

手順

VNC パスワードを割り当てる仮想マシンの設定を開きます。

# virsh edit <vm-name>設定の

<graphics>行に、passwd属性とパスワード文字列を追加します。パスワードは 8 文字以下にする必要があります。<graphics type='vnc' ports='-1' autoport=yes listen=127.0.0.1 passwd='<password>'>オプション: さらに、パスワードの有効期限が切れる日時を定義します。

<graphics type='vnc' ports='-1' autoport=yes listen=127.0.0.1 passwd='<password>' passwdValidTo='2025-02-01T15:30:00'>この例では、パスワードは 2025 年 2 月 1 日 15:30 UTC に期限切れになります。

- 設定を保存します。

検証

変更した仮想マシンを起動します。

# virsh start <vm-name>たとえば、

virt-viewerユーティリティーを使用して、仮想マシンのグラフィカルコンソールを開きます。# virt-viewer <vm-name>VNC パスワードが正しく設定されている場合は、パスワードの入力を要求するダイアログウィンドウが表示されます。

第6章 仮想マシンのシャットダウン

RHEL 9 でホストされている実行中の仮想マシンをシャットダウンするには、コマンドライン または Web コンソール GUI を使用します。

6.1. コマンドラインを使用した仮想マシンのシャットダウン

仮想マシン (VM) をシャットダウンするには、仮想マシンが応答するかどうかに応じて異なる手順が必要です。

応答可能な仮想マシンのシャットダウン

ゲストに接続している 場合は、ゲストオペレーティングシステムに適したシャットダウンコマンドまたは GUI 要素を使用します。

注記GNOME デスクトップを使用する Linux ゲストなどの一部の環境では、ゲストをサスペンドまたはハイバネート状態にするために GUI 電源ボタンを使用すると、代わりに仮想マシンがシャットダウンされることがあります。

または、ホストで

virsh shut downコマンドを使用します。仮想マシンがローカルホストにある場合は、以下のコマンドを実行します。

# virsh shutdown demo-guest1 Domain 'demo-guest1' is being shutdown仮想マシンがリモートホスト (この例では 192.0.2.1) にある場合は、以下のコマンドを実行します。

# virsh -c qemu+ssh://root@192.0.2.1/system shutdown demo-guest1 root@192.0.2.1's password: Domain 'demo-guest1' is being shutdown

応答しない仮想マシンのシャットダウン

応答しない場合など、仮想マシンを強制的にシャットダウンする場合は、そのホストで virsh destroy コマンドを実行します。

# virsh destroy demo-guest1

Domain 'demo-guest1' destroyed

virsh destroy コマンドは、仮想マシンの設定またはディスクイメージを削除するわけではありません。物理マシンから電源コードを抜くのと同様に、仮想マシンの実行中のインスタンスを終了するだけです。

virsh destroy によって、仮想マシンのファイルシステムが破損することがまれにあります。そのため、他のすべてのシャットダウン方法が失敗した場合にのみ、このコマンドを使用することを推奨します。

検証

ホスト上で、仮想マシンのリストを表示してステータスを確認します。

# virsh list --all Id Name State ------------------------------------------ 1 demo-guest1 shut off

6.2. Web コンソールを使用した仮想マシンのシャットダウンおよび再起動

RHEL 9 Web コンソールを使用して、実行中の仮想マシンを シャットダウン または 再起動 できます。仮想マシンが応答しない場合は、マスク不可割り込みを送信できます。

6.2.1. Web コンソールで仮想マシンのシャットダウン

仮想マシンが 稼働 状態であれば、RHEL 9 Web コンソールを使用してシャットダウンできます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

手順

- インターフェイスで、シャットダウンする仮想マシンがある行を見つけます。

行の右側で、 をクリックします。

仮想マシンがシャットダウンします。

トラブルシューティング

- 仮想マシンがシャットダウンしない場合には、 ボタンの横にある をクリックして、 を選択します。

- 応答しない仮想マシンをシャットダウンするには、マスク不可割り込みを送信 することもできます。

6.2.2. Web コンソールを使用した仮想マシンの再起動

仮想マシンが 稼働 状態であれば、RHEL 9 Web コンソールを使用して再起動できます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

手順

- インターフェイスで、再起動する仮想マシンの行を見つけます。

行の右側にあるメニューボタン をクリックします。

アクションのドロップダウンメニューが表示されます。

ドロップダウンメニューで、 をクリックします。

仮想マシンがシャットダウンして再起動します。

トラブルシューティング

- 仮想マシンが再起動しない場合には ボタンのとなりにある をクリックして を選択します。

- 応答しない仮想マシンをシャットダウンするには、マスク不可割り込みを送信 することもできます。

6.2.3. Web コンソールでマスク不可割り込みを仮想マシンに送信する手順

NMI (マスク不可割り込み) を送信すると、応答しない稼働中の仮想マシンが応答またはシャットダウンする可能性があります。たとえば、Ctrl+Alt+Del の NMI を、標準入力に応答しない仮想マシンに送信できます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

- インターフェイスで、NMI を送信する仮想マシンの行を見つけます。

行の右側にあるメニューボタン をクリックします。

アクションのドロップダウンメニューが表示されます。

ドロップダウンメニューで、 をクリックします。

NMI が仮想マシンに送信されます。

第7章 仮想マシンの削除

RHEL 9 で仮想マシンを削除するには、コマンドライン または Web コンソール GUI を使用します。

7.1. コマンドラインを使用した仮想マシンの削除

仮想マシンを削除するには、コマンドラインでその XML 設定および関連するストレージファイルをホストから削除します。以下の手順を実施します。

前提条件

- 仮想マシンからの重要なデータのバックアップを作成している。

- 仮想マシンをシャットダウンしている。

- その他の仮想マシンが、同じ関連ストレージを使用しないようにしている。

手順

virsh undefineユーティリティーを使用します。たとえば、次のコマンドは、guest1 仮想マシン、関連のあるストレージボリューム、および不揮発性 RAM が存在する場合はそれを削除します。

# virsh undefine guest1 --remove-all-storage --nvram Domain 'guest1' has been undefined Volume 'vda'(/home/images/guest1.qcow2) removed.

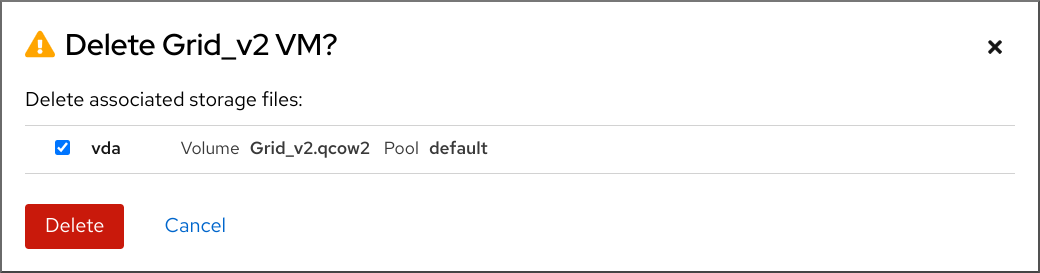

7.2. Web コンソールを使用した仮想マシンの削除

RHEL 9 Web コンソールが接続しているホストから、仮想マシンおよび関連ストレージファイルを削除する場合は、以下の手順を行います。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

- 仮想マシンからの重要なデータのバックアップを作成している。

- 他の仮想マシンが同じ関連ストレージを使用していないことを確認します。

- オプション: 仮想マシンをシャットダウンします。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

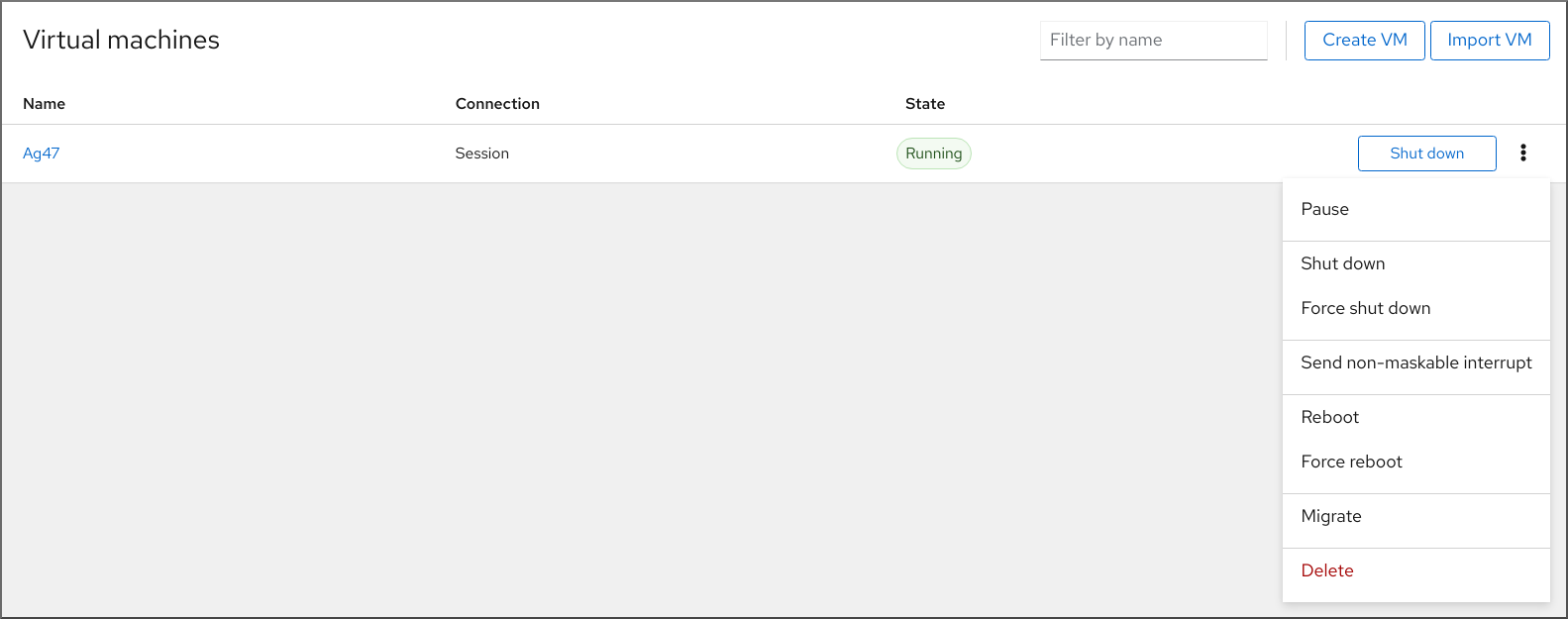

インターフェイスで、削除する仮想マシンのメニューボタン をクリックします。

仮想マシン操作を制御するためのドロップダウンメニューが表示されます。

をクリックします。

確認ダイアログが表示されます。

- オプション: 仮想マシンに関連付けられているストレージファイルのすべてまたは一部を削除するには、削除するストレージファイルの横にあるチェックボックスをオンにします。

をクリックします。

仮想マシンと、選択したストレージファイルが削除されます。

第8章 Web コンソールでの仮想マシンの管理

RHEL 9 ホストのグラフィカルインターフェイスで仮想マシンを管理する場合は、RHEL 9 Web コンソールの Virtual Machines ペインを使用できます。

8.1. Web コンソールを使用した仮想マシンの管理の概要

RHEL 9 Web コンソールは、Web ベースのシステム管理インターフェイスです。Web コンソールは、その機能の 1 つとして、ホストシステムで仮想マシンをグラフィカルに表示してその仮想マシンの作成、アクセス、および設定を可能にします。

Web コンソールを使用して RHEL 9 で仮想マシンを管理するには、最初に、仮想化用の Web コンソールプラグイン をインストールする必要があります。

次のステップ

- Web コンソールで仮想マシンの管理を有効にする手順は、Web コンソールの設定による仮想マシンの管理 を参照してください。

- Web コンソールで使用できる仮想マシン管理アクションの包括的なリストは、Virtual machine management features available in the web console を参照してください。

8.2. 仮想マシンを管理するために Web コンソールを設定

Web コンソールの仮想マシン (VM) プラグインをインストールして、RHEL 9 Web コンソールを使用してホストで仮想マシンを管理できるようにしてある。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

手順

cockpit-machinesプラグインをインストールします。# dnf install cockpit-machines

検証

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

インストールに成功すると、 が Web コンソールのサイドメニューに表示されます。

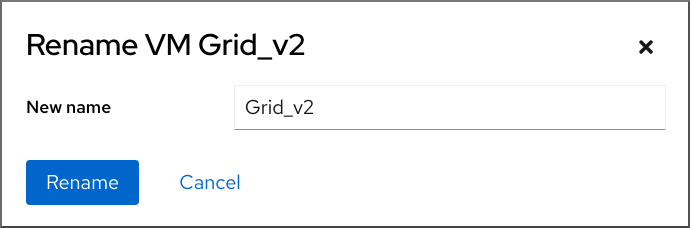

8.3. Web コンソールを使用した仮想マシンの名前の変更

名前の競合を避けるために、またはユースケースに基づいて新しい一意の名前を割り当てるために、既存の仮想マシンの名前を変更することが必要な場合があります。RHEL Web コンソールを使用して仮想マシンの名前を変更できます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

- 仮想マシンがシャットダウンされている。

手順

インターフェイスで、名前を変更する仮想マシンのメニューボタン をクリックします。

仮想マシン操作を制御するためのドロップダウンメニューが表示されます。

をクリックします。

Rename a VM ダイアログが表示されます。

- New name フィールドに、仮想マシンの名前を入力します。

- をクリックします。

検証

- 新しい仮想マシン名が インターフェイスに表示されていることを確認します。

8.4. Web コンソールで利用可能な仮想マシンの管理機能

RHEL 9 Web コンソールを使用すると、システム上の仮想マシンを管理する以下のアクションを実行できます。

| タスク | 詳細は以下参照 |

|---|---|

| 仮想マシンの作成およびゲストオペレーティングシステムでのインストール | |

| 仮想マシンの削除 | |

| 仮想マシンび起動、シャットダウンし、再起動 | |

| さまざまなコンソールを使用した仮想マシンへの接続および操作 | |

| 仮想マシンに関するさまざまな情報の表示 | |

| 仮想マシンのネットワーク接続管理 | |

| ホストでの利用可能な仮想マシンストレージ管理および仮想ディスクを仮想マシンへの割り当て | |

| 仮想マシンの仮想 CPU 設定 | |

| 仮想マシンのライブマイグレーション | |

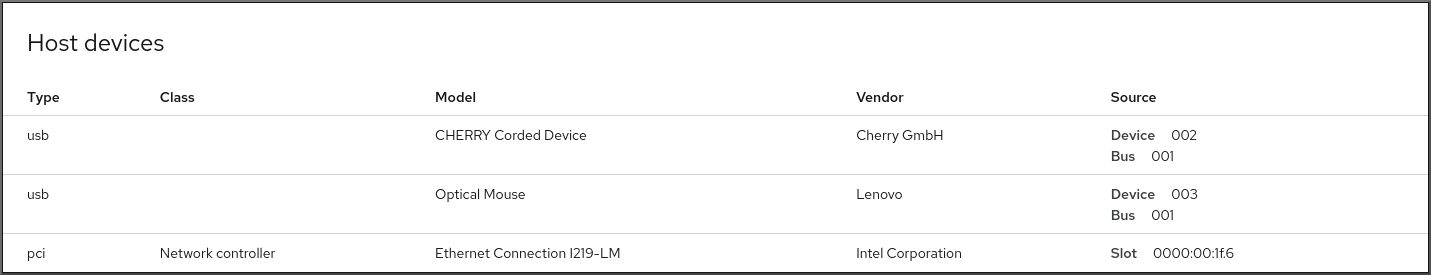

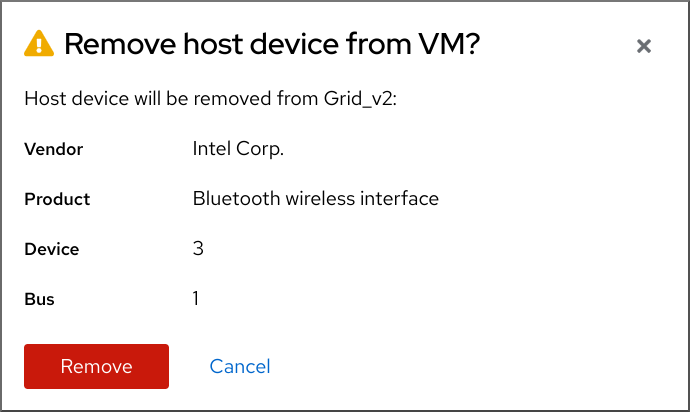

| ホストデバイスの管理 | |

| 仮想光学ドライブを管理する | |

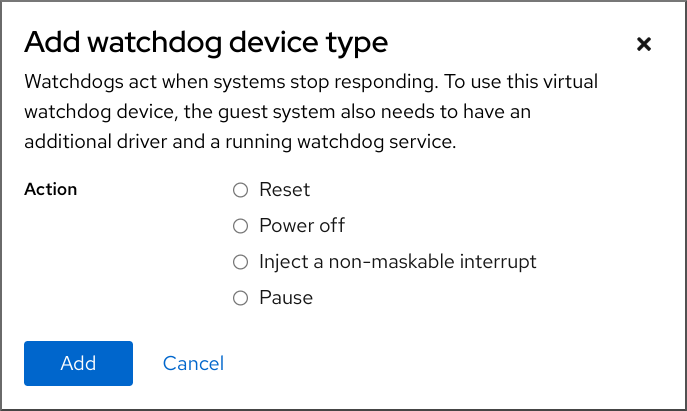

| ウォッチドッグデバイスを接続する |

第9章 仮想マシンに関する情報の表示

RHEL 9 での仮想化デプロイメントのあらゆる側面を調整またはトラブルシューティングする必要がある場合、通常、最初に実行する必要がある手順は、仮想マシン (VM) の現在の状態と設定に関する情報を表示することです。これは、コマンドライン または Web コンソール を使用して実行できます。仮想マシンの XML 設定 で情報を表示することもできます。

9.1. コマンドラインを使用した仮想マシン情報の表示

ホストおよびその設定で仮想マシンに関する情報を取得するには、以下のコマンドのいずれかまたは複数コマンドを使用します。

手順

ホストで仮想マシンのリストを取得するには、次のコマンドを実行します。

# virsh list --all Id Name State ---------------------------------- 1 testguest1 running - testguest2 shut off - testguest3 shut off - testguest4 shut off特定の仮想マシンに関する基本的な情報を取得するには、次のコマンドを実行します。

# virsh dominfo testguest1 Id: 1 Name: testguest1 UUID: a973666f-2f6e-415a-8949-75a7a98569e1 OS Type: hvm State: running CPU(s): 2 CPU time: 188.3s Max memory: 4194304 KiB Used memory: 4194304 KiB Persistent: yes Autostart: disable Managed save: no Security model: selinux Security DOI: 0 Security label: system_u:system_r:svirt_t:s0:c486,c538 (enforcing)特定の仮想マシンの XML 設定をすべて取得するには、次のコマンドを実行します。

# virsh dumpxml testguest2 <domain type='kvm' id='1'> <name>testguest2</name> <uuid>a973434f-2f6e-4ěša-8949-76a7a98569e1</uuid> <metadata> [...]仮想マシンの XML 設定の例と注釈は、仮想マシンの XML 設定例 を参照してください。

仮想マシンのディスクおよびその他のブロックデバイスに関する情報は、次のコマンドを実行します。

# virsh domblklist testguest3 Target Source --------------------------------------------------------------- vda /var/lib/libvirt/images/testguest3.qcow2 sda - sdb /home/username/Downloads/virt-p2v-1.36.10-1.el7.iso仮想マシンのストレージを管理する手順は、Managing storage for virtual machines を参照してください。

仮想マシンのファイルシステムとそのマウントポイントに関する情報を取得するには、次のコマンドを実行します。

# virsh domfsinfo testguest3 Mountpoint Name Type Target ------------------------------------ / dm-0 xfs /boot vda1 xfs

特定の仮想マシンの vCPU に関する詳細を取得するには、次のコマンドを実行します。

# virsh vcpuinfo testguest4 VCPU: 0 CPU: 3 State: running CPU time: 103.1s CPU Affinity: yyyy VCPU: 1 CPU: 0 State: running CPU time: 88.6s CPU Affinity: yyyy仮想マシンで vCPU を設定し、最適化するには、仮想マシンの CPU パフォーマンスの最適化 を参照してください。

ホスト上の仮想ネットワークインターフェイスのリストを表示するには、次のコマンドを実行します。

# virsh net-list --all Name State Autostart Persistent --------------------------------------------- default active yes yes labnet active yes yes特定のインターフェイスに関する情報は、次のコマンドを実行します。

# virsh net-info default Name: default UUID: c699f9f6-9202-4ca8-91d0-6b8cb9024116 Active: yes Persistent: yes Autostart: yes Bridge: virbr0ネットワークインターフェイス、仮想マシンネットワーク、およびこれらの設定手順の詳細は、仮想マシンのネットワーク接続の設定 を参照してください。

- ホスト上のストレージプールとストレージボリュームに関する情報を表示する手順は、CLI を使用した仮想マシンのストレージ情報の表示 を参照してください。

9.2. Web コンソールを使用した仮想マシン情報の表示

RHEL 9 Web コンソールを使用して、Web コンソールセッションがアクセスできるすべての 仮想マシン および ストレージプール に関する情報を表示することができます。

Web コンソールセッションの接続先である 選択した仮想マシンに関する情報 を表示できます。これには、ディスク、仮想ネットワークインターフェイス、および リソースの使用量 に関する情報が含まれます。

9.2.1. Web コンソールで仮想化の概要を表示

Web コンソールを使用して、仮想マシン、ストレージプール、およびネットワークに関する概要情報を含む仮想化の概要にアクセスできます。

前提条件

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

手順

Web コンソールのサイドメニューで、 をクリックします。

利用可能なストレージプール、利用可能なネットワーク、および Web コンソールが接続する仮想マシンに関する情報を含むダイアログボックスが表示されます。

この情報には以下が含まれます。

- ストレージプール - Web コンソールからアクセス可能なストレージプールの数とその状態です (アクティブまたは非アクティブ)。

- ネットワーク - Web コンソールからアクセス可能なネットワークの数とその状態です (アクティブまたは非アクティブ)。

- 名前 - 仮想マシンの名前

- 接続 - libvirt 接続、システム、またはセッションの種類。

- 状態 - 仮想マシンの状態

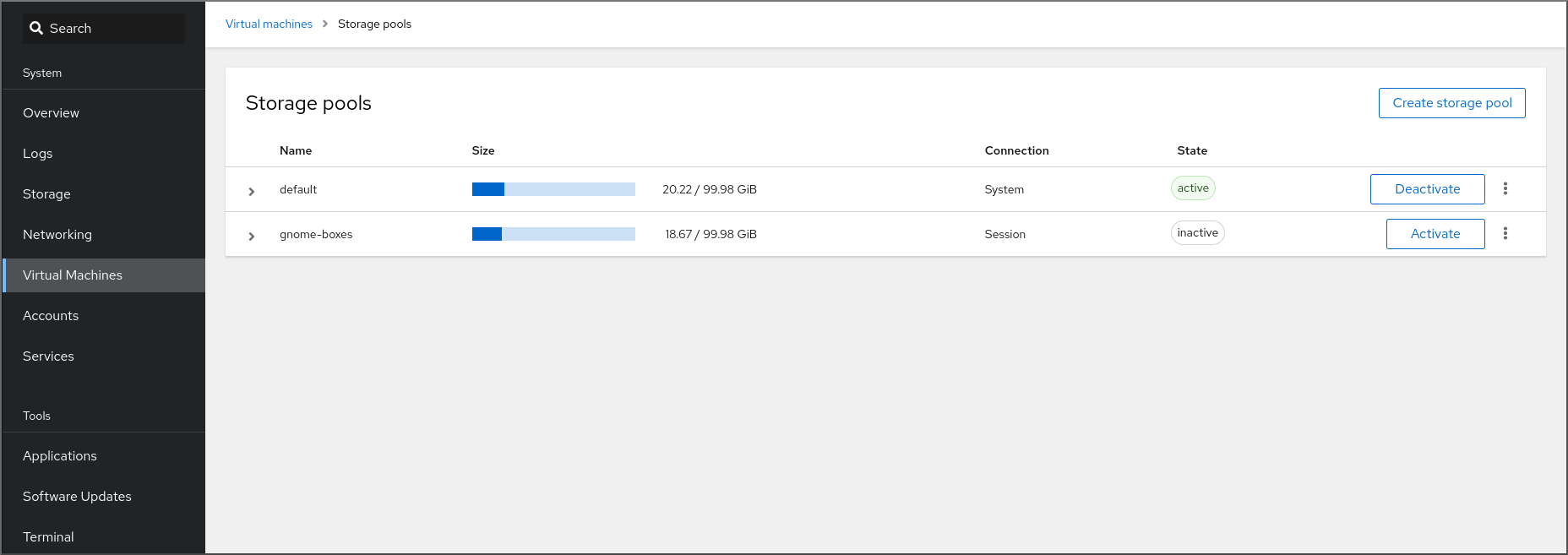

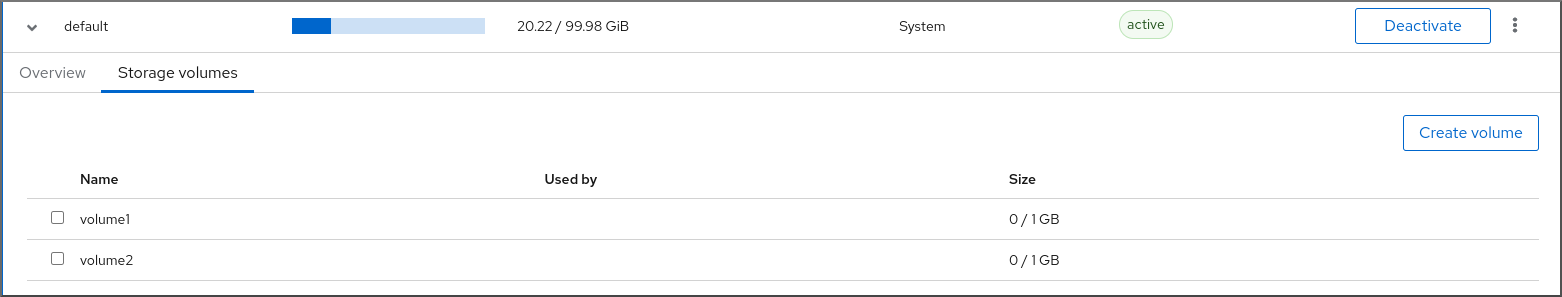

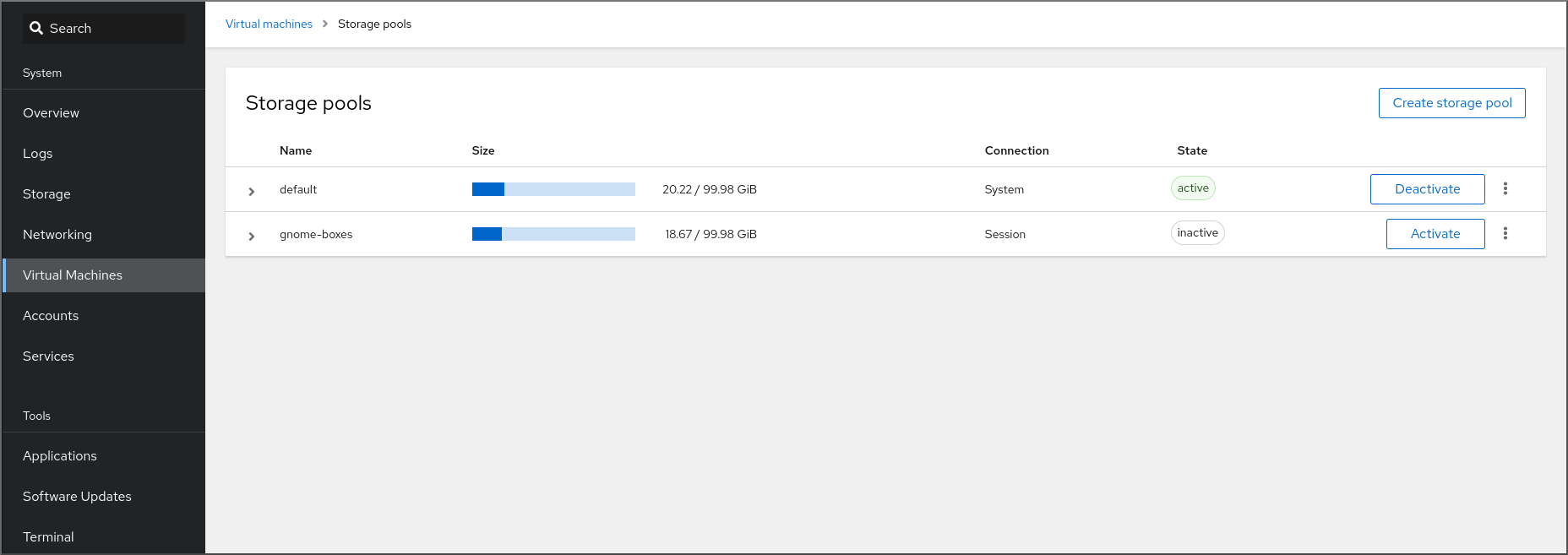

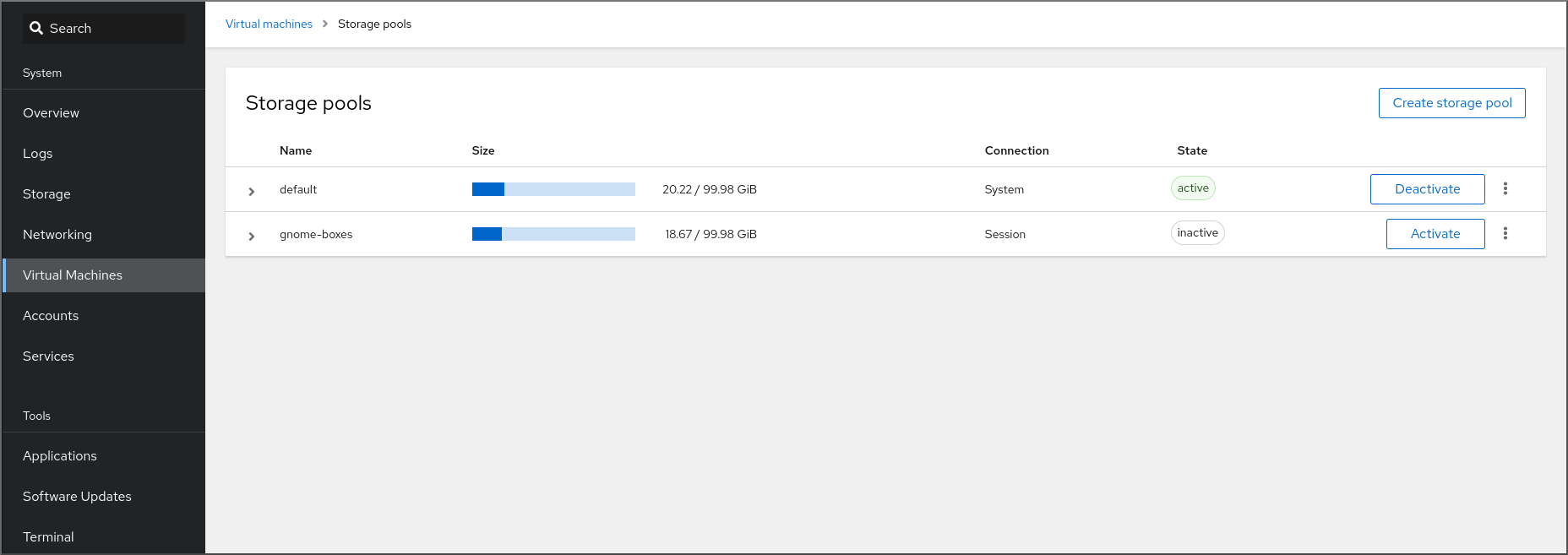

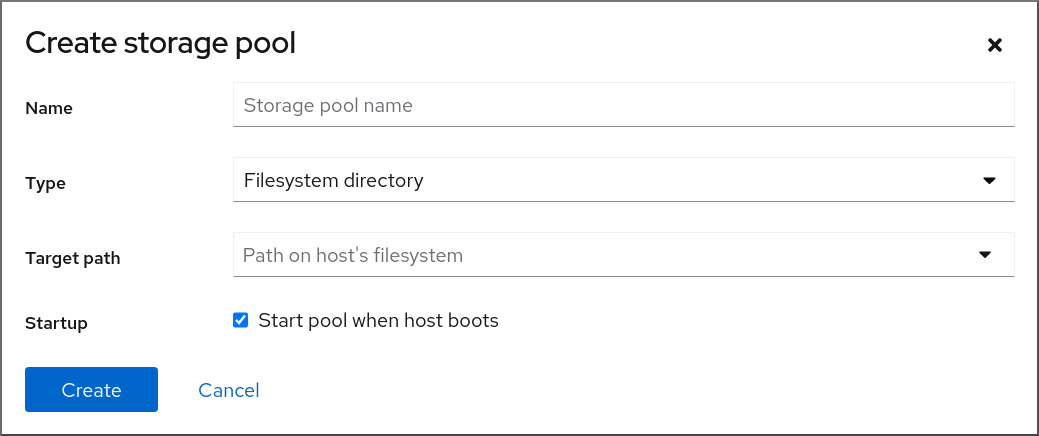

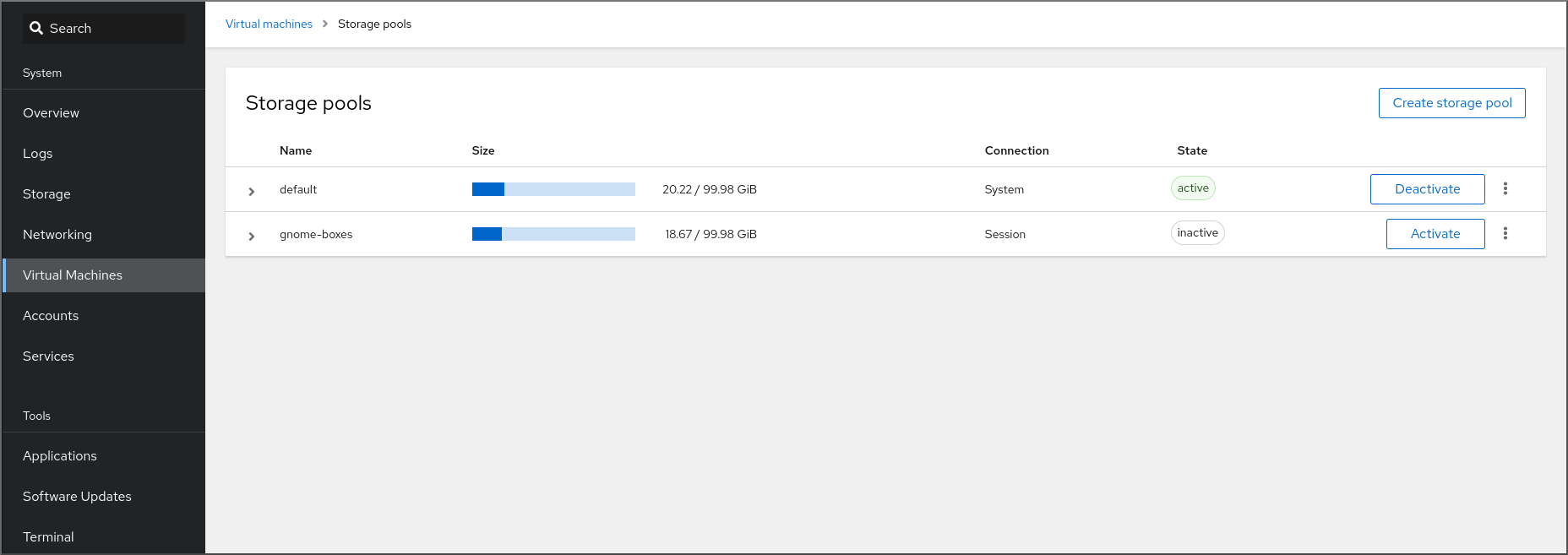

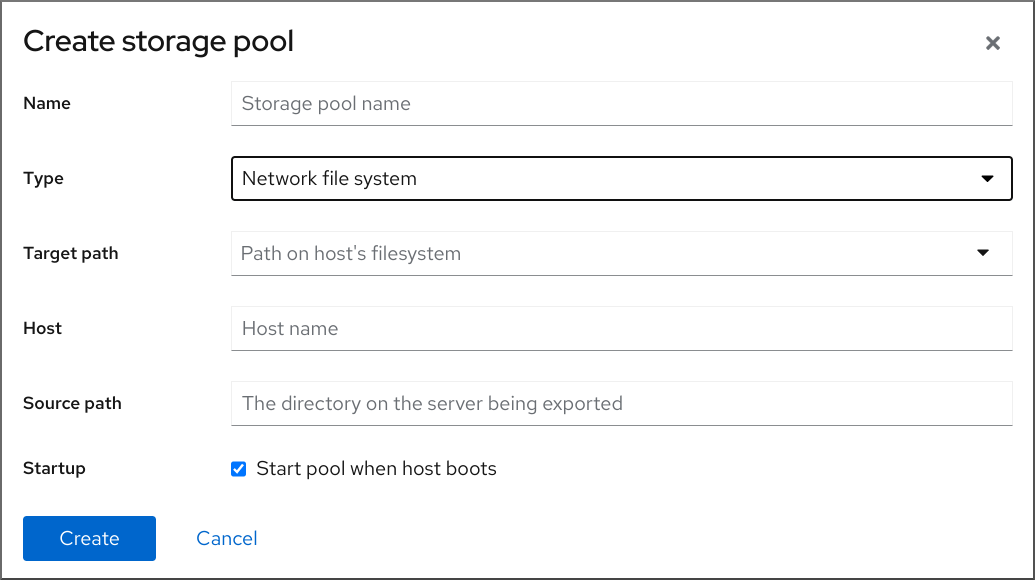

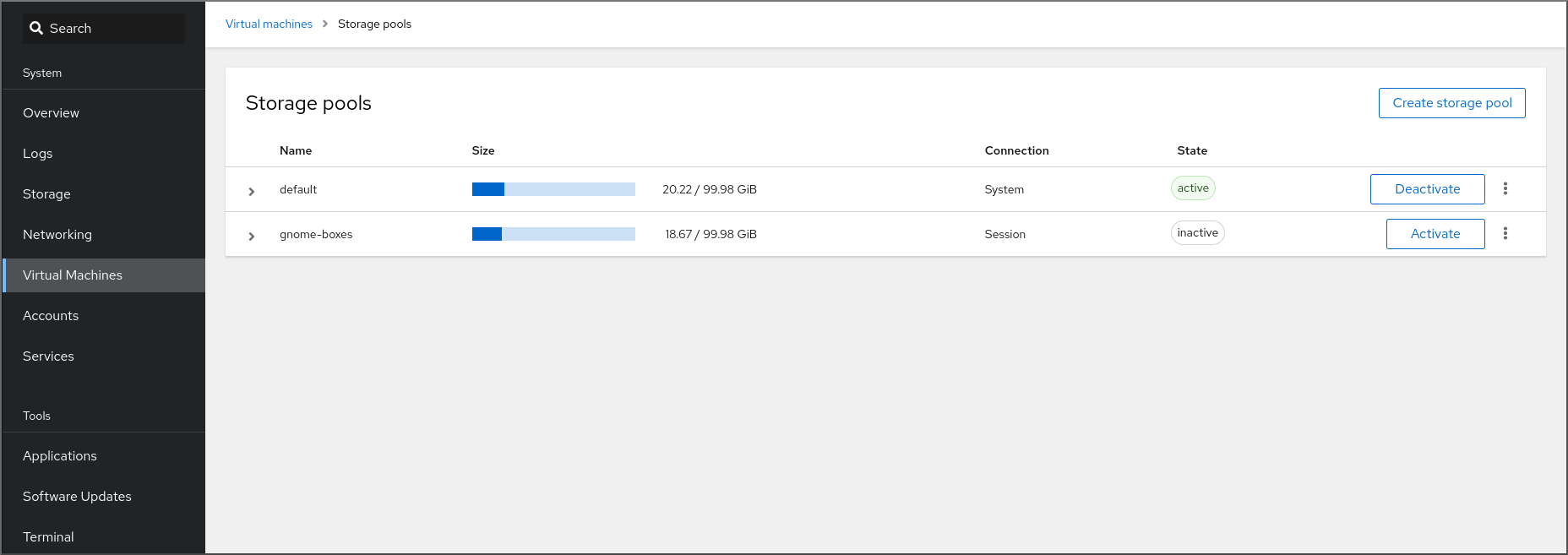

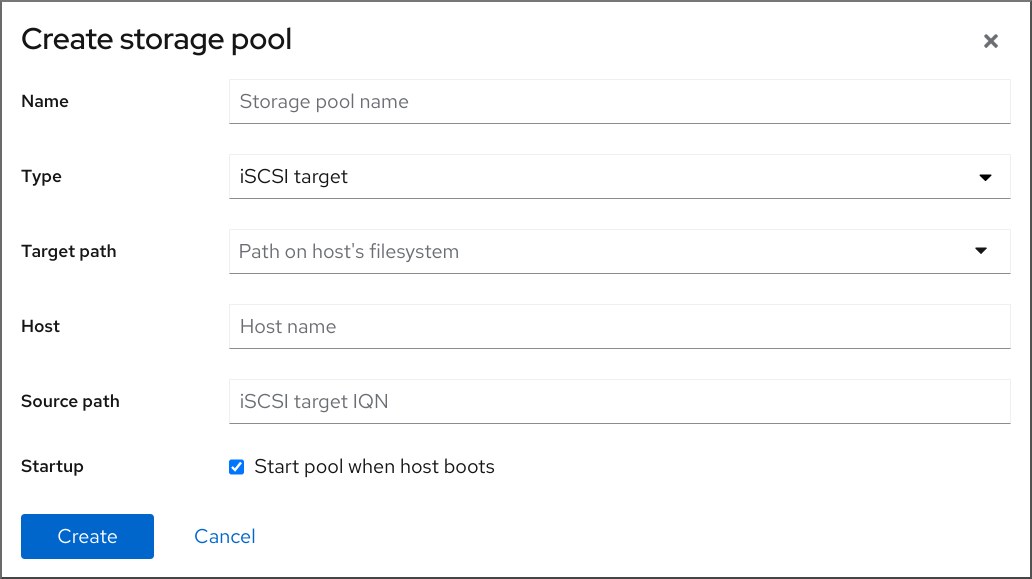

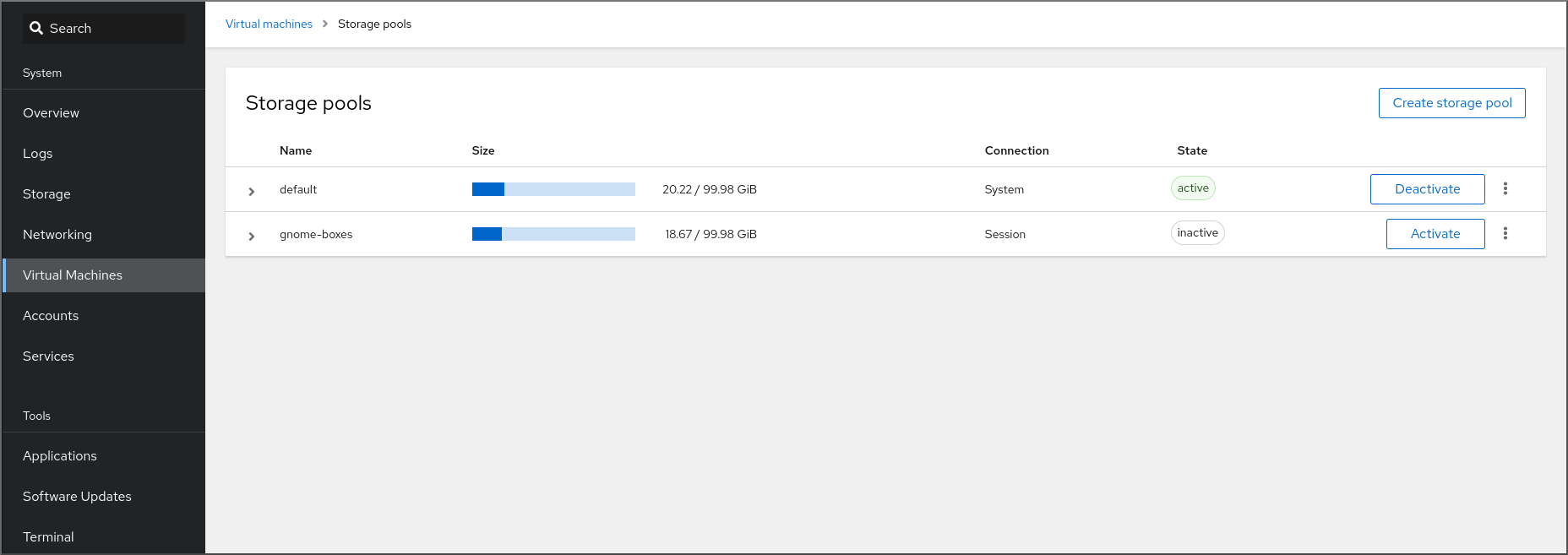

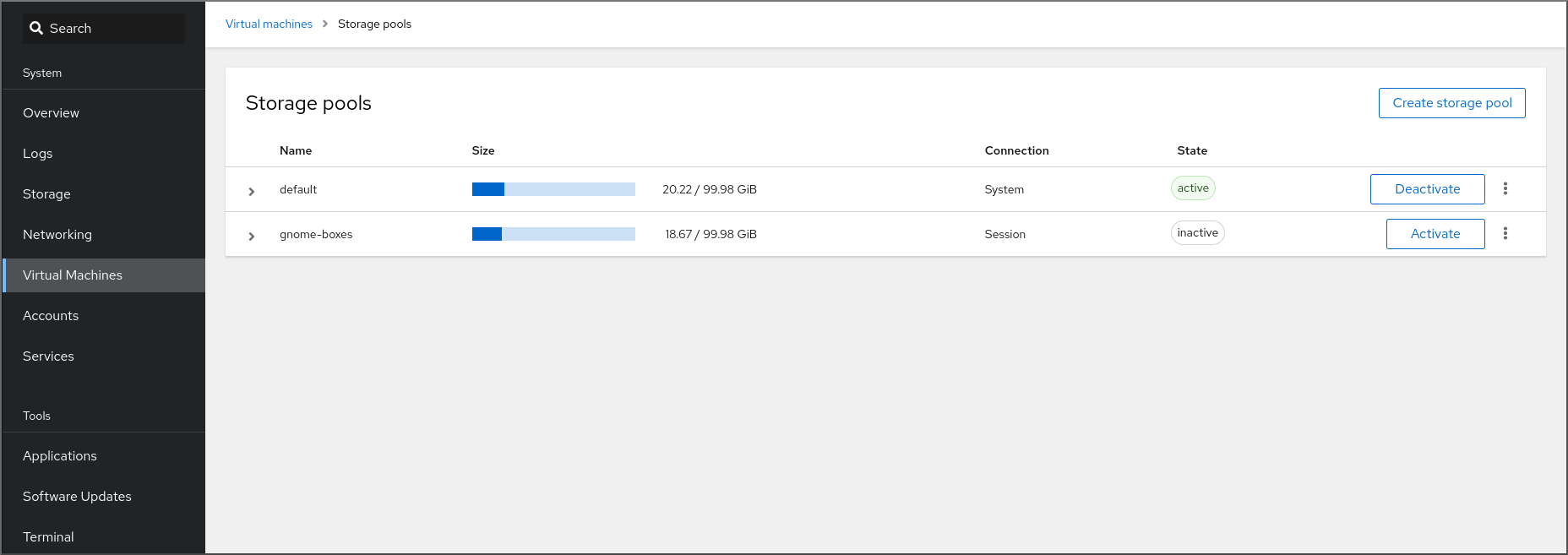

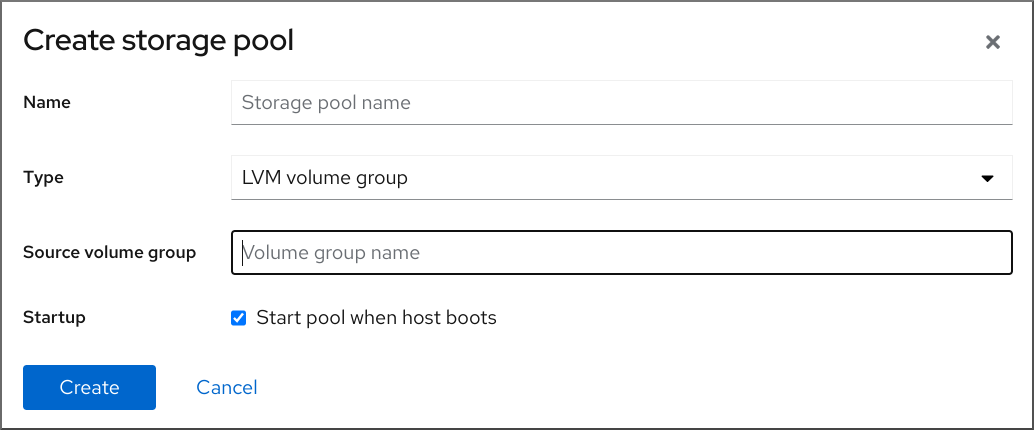

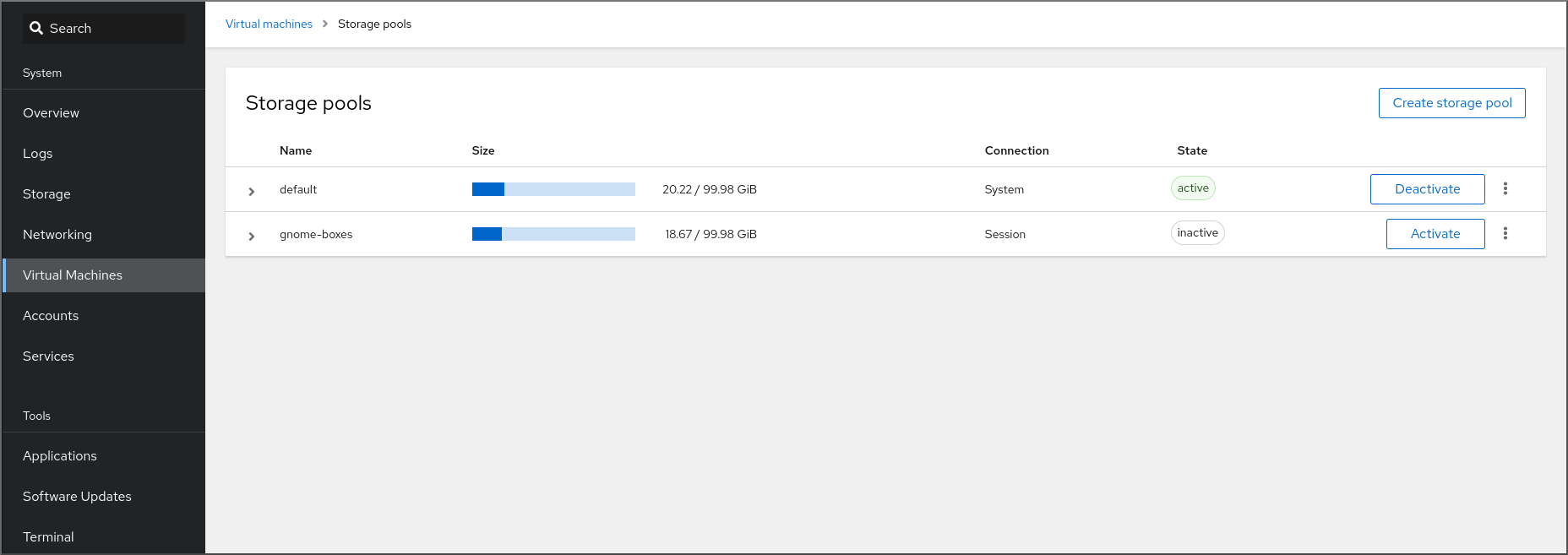

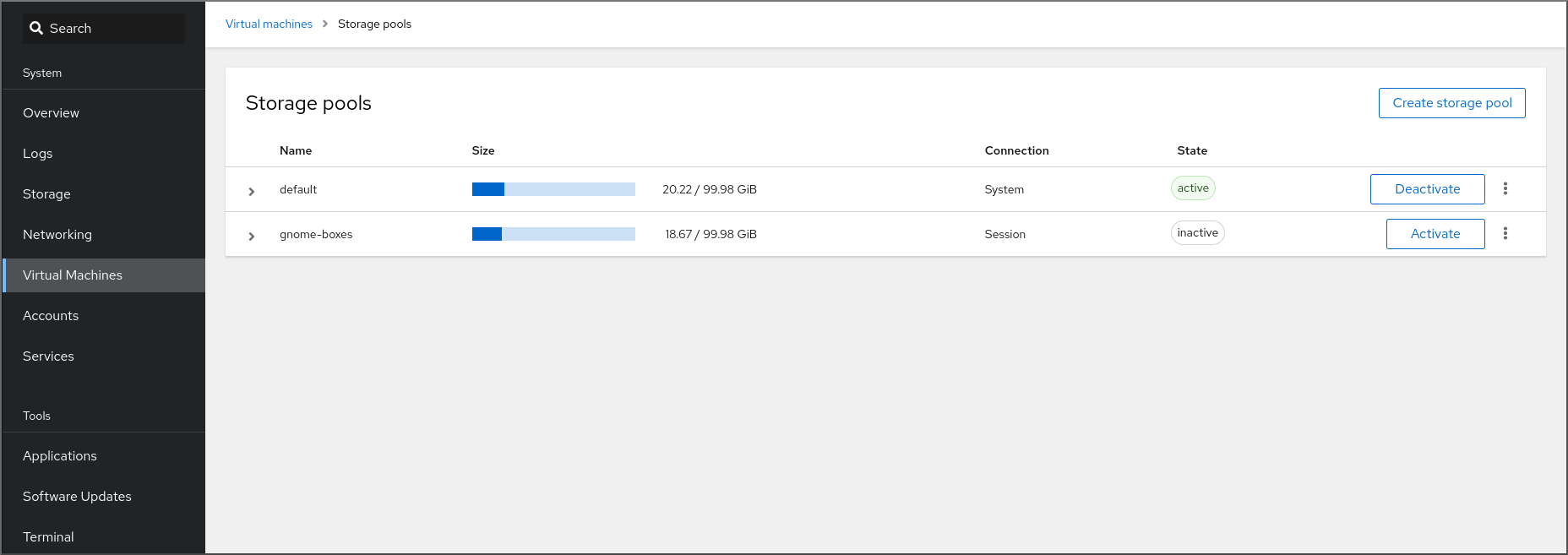

9.2.2. Web コンソールを使用したストレージプール情報の表示

Web コンソールを使用して、システムで利用可能なストレージプールの詳細情報を表示できます。ストレージプールを使用すると、仮想マシンのディスクイメージを作成できます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

インターフェイスで をクリックします。

Storage pools 画面が表示され、設定されているストレージプールの一覧が示されます。

この情報には以下が含まれます。

- Name - ストレージプールの名前。

- Size - ストレージプールの現在の割り当てと合計容量。

- Connection - ストレージプールへのアクセスに使用される接続。

- State - ストレージプールの状態。

情報を表示するストレージプールの横にある矢印をクリックします。

行がデプロイメントされ、選択したストレージプールに関する詳細情報を含む概要ペインが表示されます。

この情報には以下が含まれます。

- Target path - ストレージプールの場所です。

- Persistent - ストレージプールの設定が永続的であるかどうかを示します。

- Autostart - システムの起動時にストレージプールが自動的に起動するかどうかを示します。

- Type - ストレージプールの種類。

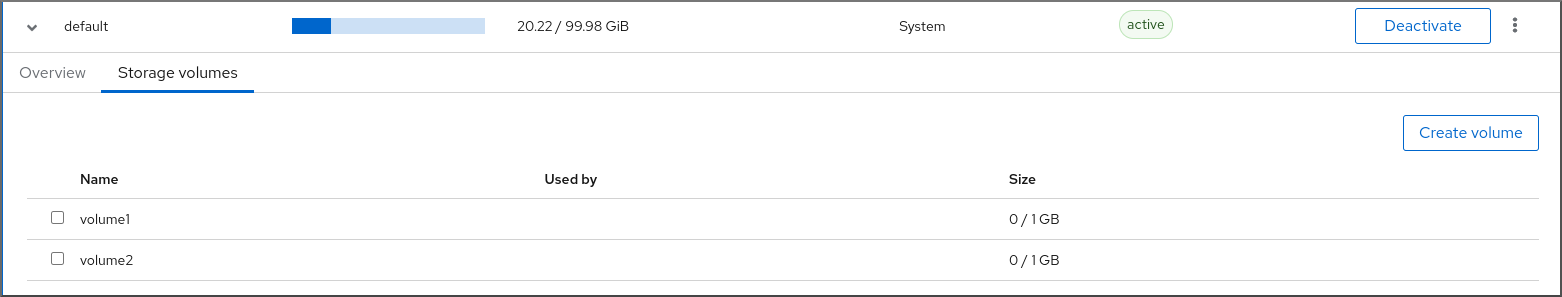

ストレージプールに関連付けられているストレージボリュームのリストを表示する場合は、 をクリックします。

ストレージボリュームペインが表示され、設定したストレージボリュームのリストが表示されます。

この情報には以下が含まれます。

- Name - ストレージボリュームの名前。

- Used by - 現在ストレージボリュームを使用している仮想マシン。

- サイズ - ボリュームのサイズ。

9.2.3. Web コンソールで仮想マシン基本情報の表示

Web コンソールを使用して、選択した仮想マシンに関する基本情報 (割り当てられたリソース、ハイパーバイザーの詳細など) を表示できます。

前提条件

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

- Web コンソールのサイドメニューで、 をクリックします。

情報を表示する仮想マシンをクリックします。

新しいページが開き、選択した仮想マシンに関する基本情報を含む Overview セクションと、仮想マシンのグラフィカルインターフェイスにアクセスするための Console セクションが表示されます。

概要セクションには、次の一般的な仮想マシンの詳細が記載されています。

- 状態 - 仮想マシンの状態 (実行中またはシャットオフ)。

- メモリー - 仮想マシンに割り当てるメモリー容量

- CPU - 仮想マシンに設定されている仮想 CPU の数とタイプ。

- ブート順序 - 仮想マシンに設定されたブート順序

- 自動起動 - 仮想マシンで自動起動が有効になっているかどうか

この情報には、以下のハイパーバイザーの詳細も含まれます。

- エミュレートされたマシン - 仮想マシンによりエミュレートされたマシンタイプ

- ファームウェア - 仮想マシンのファームウェア。

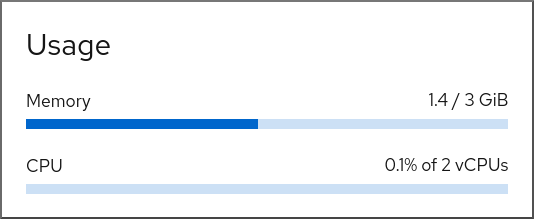

9.2.4. Web コンソールで仮想マシンのリソース使用状況の表示

Web コンソールを使用して、選択した仮想マシンのメモリーと仮想 CPU 使用率を表示できます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

インターフェイスで、情報を表示する仮想マシンを選択します。

新しいページが開き、選択した仮想マシンに関する基本情報を含む Overview セクションと、仮想マシンのグラフィカルインターフェイスにアクセスするための Console セクションが表示されます。

までスクロールします。

使用率セクションには、仮想マシンのメモリーおよび仮想 CPU 使用率に関する情報が表示されます。

9.2.5. Web コンソールで仮想マシンのディスク情報の表示

Web コンソールを使用して、選択した仮想マシンに割り当てられたディスクの詳細情報を表示できます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

情報を表示する仮想マシンをクリックします。

新しいページが開き、選択した仮想マシンに関する基本情報を含む Overview セクションと、仮想マシンのグラフィカルインターフェイスにアクセスするための Console セクションが表示されます。

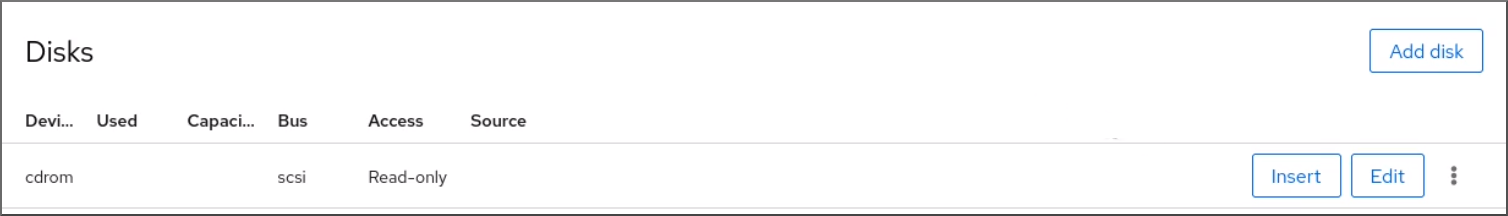

までスクロールします。

ディスクセクションには、仮想マシンに割り当てられたディスクに関する情報と、ディスクの Add、または Edit のオプションが表示されます。

この情報には以下が含まれます。

- Device - ディスクのデバイスの種類。

- Used - 現在割り当てられているディスク容量。

- Capacity - ストレージボリュームの最大サイズ。

- Bus - エミュレートされているディスクデバイスの種類。

-

Access - ディスクが Writeable 可能か Read-only か。

rawディスクの場合、アクセスを Writeable and shared に設定することもできます。 - Source - ディスクデバイスまたはファイル。

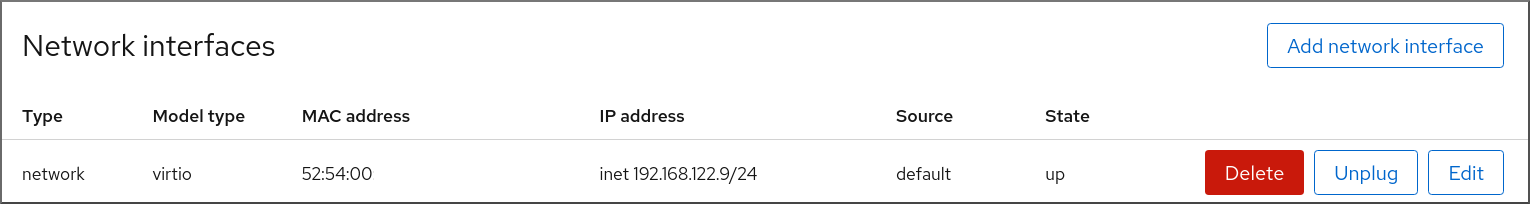

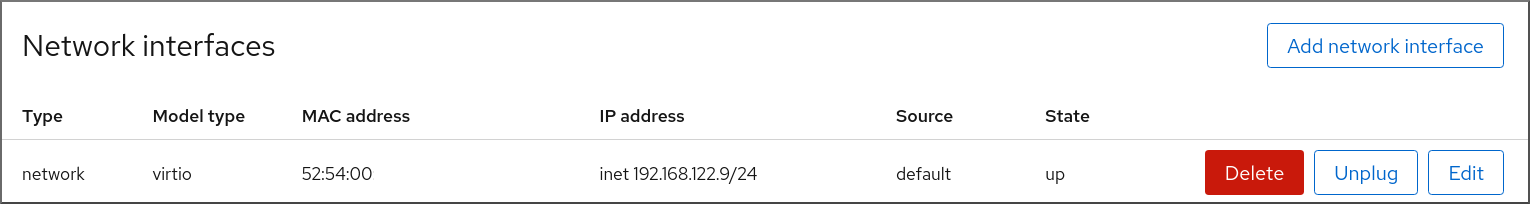

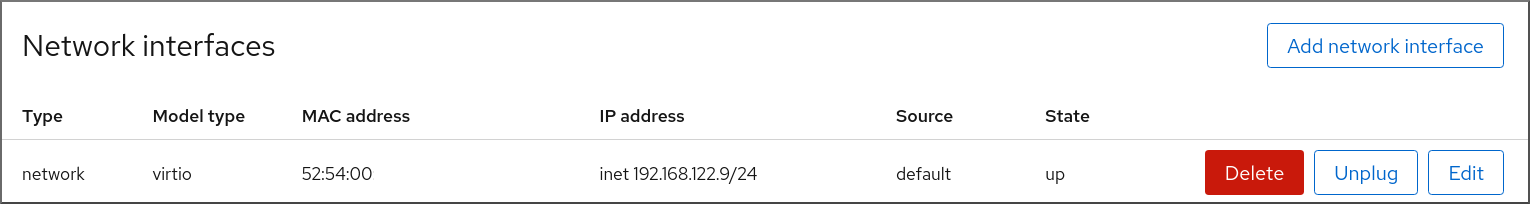

9.2.6. Web コンソールで仮想ネットワークインターフェイス情報の表示および編集

RHEL 9 Web コンソールを使用して、選択した仮想マシンで仮想ネットワークインターフェイスを表示および変更することができます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

インターフェイスで、情報を表示する仮想マシンを選択します。

新しいページが開き、選択した仮想マシンに関する基本情報を含む Overview セクションと、仮想マシンのグラフィカルインターフェイスにアクセスするための Console セクションが表示されます。

までスクロールします。

ネットワークインターフェイスセクションには、仮想マシンに設定された仮想ネットワークインターフェイスに関する情報と、ネットワークインターフェイスの追加、削除、編集、またはアンプラグ のオプションが表示されます。

この情報には以下が含まれます。

種類 - 仮想マシンのネットワークインターフェイスの種類。タイプには、仮想ネットワーク、LAN へのブリッジ、および直接割り当てが含まれます。

注記RHEL 9 以降では、汎用イーサネット接続はサポートされていません。

- モデルタイプ - 仮想ネットワークインターフェイスのモデル。

- MAC アドレス - 仮想ネットワークインターフェイスの MAC アドレス。

- IP アドレス - 仮想ネットワークインターフェイスの IP アドレス。

- ソース - ネットワークインターフェイスのソース。これはネットワークの種類によって異なります。

- 状態 - 仮想ネットワークインターフェイスの状態。

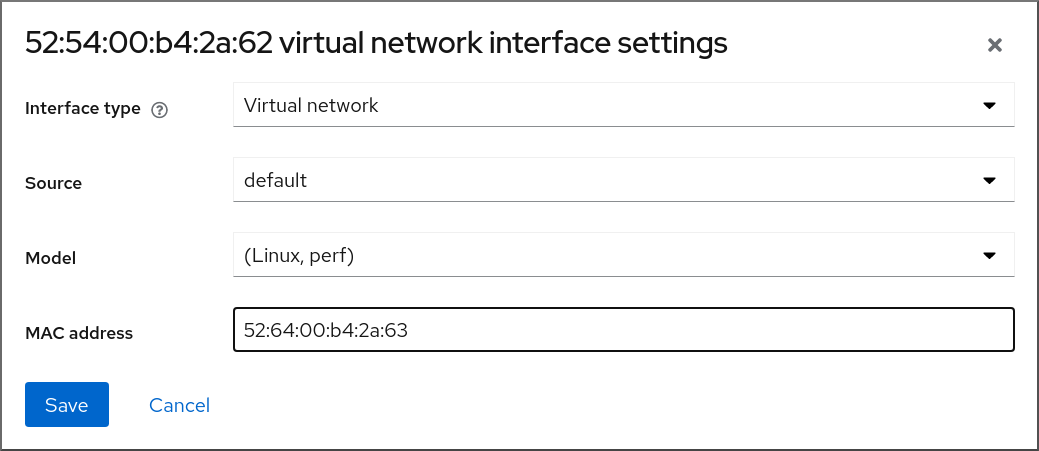

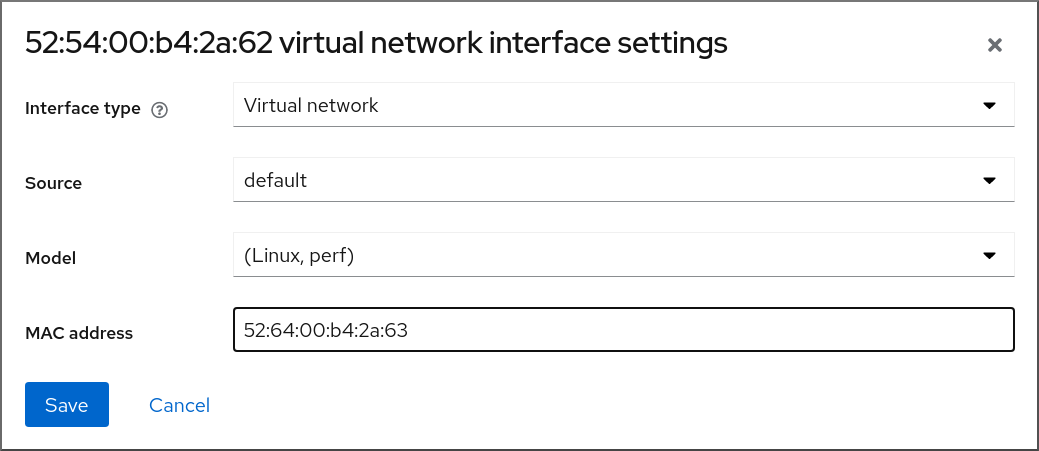

仮想ネットワークインターフェイスの設定を編集するには、 をクリックします。仮想ネットワークインターフェイスの設定ダイアログが開きます。

- インターフェイスの種類、ソース、モデル、または MAC アドレスを変更します。

をクリックします。ネットワークインターフェイスが変更しました。

注記仮想ネットワークインターフェイス設定の変更は、仮想マシンを再起動しないと有効になりません。

また、MAC アドレスは、仮想マシンがシャットダウンしている場合にのみ変更できます。

9.3. 仮想マシンの XML 設定例

仮想マシンの XML 設定 (ドメイン XML とも呼ばれる) は、仮想マシンの設定およびコンポーネントを決定します。以下の表は、仮想マシンの XML 設定例の各セクションと、コンテンツを説明しています。

仮想マシンの XML 設定を取得するには、virsh dumpxml コマンドの後に仮想マシンの名前を指定します。

# virsh dumpxml testguest1| ドメイン XML セクション | 説明 |

|---|---|

| これは、1024 MiB のメモリーが割り当てられている KVM 仮想マシン Testguest1 です。 |

| 仮想マシンには、仮想 CPU (vCPU) が 1 つ割り当てられます。 vCPU の設定に関する詳細は、仮想マシンの CPU パフォーマンスの最適化 を参照してください。 |

| マシンアーキテクチャーは AMD64 および Intel 64 のアーキテクチャーに設定され、Intel Q35 マシン種別を使用して機能の互換性を決定します。OS は、ハードディスクドライブから起動するように設定されています。 OS がインストールされた仮想マシンの作成は、Web コンソールを使用した仮想マシンの作成、およびゲストのオペレーティングシステムのインストール を参照してください。 |

| acpi および apic ハイパーバイザー機能が有効になります。 |

|

機能 XML ( |

| 仮想マシンの仮想ハードウェアクロックは UTC タイムゾーンを使用します。また、QEMU ハイパーバイザーと同期するために、異なるタイマーが 3 つ設定されます。 |

|

仮想マシンの電源が切れた場合や、仮想マシンの OS が突然終了すると、 |

| この仮想マシンでは、S3 および S4 ACPI のスリープ状態が無効になっています。 |

|

仮想マシンは、エミュレーションに

最初のディスクは、ホストに保存されている

2 番目のディスクは仮想化 CD-ROM で、その論理デバイス名は |

|

仮想マシンは、USB デバイスの割り当てにコントローラーを 1 つ、PCI-Express (PCIe) デバイスにルートコントローラーを使用します。さらに、 仮想デバイスの詳細は、仮想デバイスの種類 を参照してください。 |

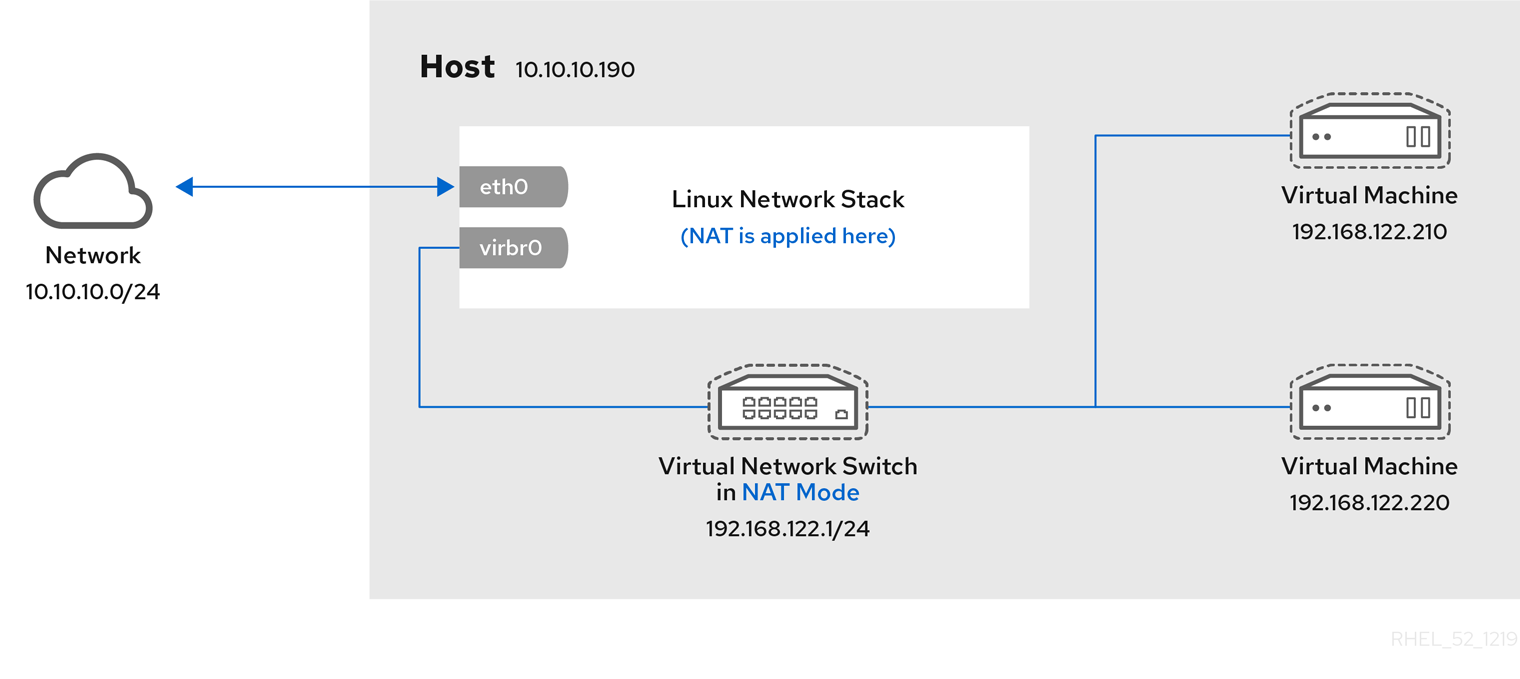

|

ネットワークインターフェイスは、 ネットワークインターフェイスの設定に関する詳細は、仮想マシンのネットワークパフォーマンスの最適化 を参照してください。 |

|

仮想マシンと相互作用する方法の詳細は、Web コンソールを使用した仮想マシンとの相互作用 を参照してください。 |

| 仮想マシンは、タブレット入力を受信するように設定された仮想 usb ポートと、マウスとキーボード入力を受け取るように設定された仮想 ps2 ポートを使用します。この設定は自動で設定されており、設定の変更は推奨されません。 |

|

仮想マシンは、グラフィカル出力をレンダリングするために |

|

仮想マシンは、USB デバイスのリモート割り当てに |

第10章 仮想マシンの保存および復元

システムリソースを解放するには、そのシステムで実行中の仮想マシンをシャットダウンできます。ただし、仮想マシンが再び必要になった場合は、ゲストオペレーティングシステム (OS) を起動し、アプリケーションを再起動する必要があります。これにはかなりの時間がかかる場合があります。このダウンタイムを短縮し、仮想マシンワークロードをより早く実行できるようにする場合は、保存機能および復元機能を使用して、OS のシャットダウンと起動シーケンスを完全に回避できます。

このセクションでは、仮想マシンの保存、および仮想マシンの完全な起動を行わずに仮想マシンを同じ状態に復元する方法を説明します。

10.1. 仮想マシンの保存および復元の仕組み

仮想マシンを保存すると、そのメモリーとデバイス状態がホストのディスクに保存され、仮想マシンプロセスがすぐに停止します。実行中または一時停止状態の仮想マシンを保存できます。復元すると、仮想マシンがその状態に戻ります。

このプロセスにより、ディスク容量と引き換えにホストシステムの RAM および CPU のリソースが解放され、ホストシステムのパフォーマンスが向上する場合があります。仮想マシンが復元する場合にゲスト OS を起動する必要がないため、時間がかかる起動時間も回避できます。

仮想マシンを保存するには、コマンドライン (CLI) を使用します。手順は、コマンドラインを使用した仮想マシンの保存 を参照してください。

仮想マシンを復元するには、CLI または Web コンソールの GUI を使用します。

スナップショットを使用して仮想マシンの状態を保存および復元することもできます。詳細は、スナップショットを使用した仮想マシンの状態の保存と復元 を参照してください。

10.2. コマンドラインを使用した仮想マシンの保存

仮想マシン (VM) と現在の状態をホストのディスクに保存できます。これは、たとえば、その他の目的でホストのリソースを使用する必要がある場合に便利です。保存した仮想マシンは、すぐに以前の稼働状態に復元できます。

コマンドラインを使用して仮想マシンを保存するには、以下の手順を行います。

前提条件

- 仮想マシンと設定を保存するのに十分なディスク領域がある。仮想マシンが占有する領域は、その仮想マシンに割り当てられている RAM のサイズによって異なることに注意してください。

仮想マシンが永続的である。

# virsh list --persistent --all- オプション: 必要に応じて、仮想マシンから重要なデータをバックアップする。

手順

オプション: 保存された仮想マシン状態のイメージ圧縮を最適化するために、イメージのフォーマットを指定できます。これにより保存される仮想マシンファイルのサイズは小さくなりますが、必要な展開処理のため、保存および再読み込み処理が遅くなる可能性があります。

/etc/libvirt/qemu.confファイルで、save_image_formatパラメーターの値を以下のいずれかの形式に変更してください。- zstd - 最適なパフォーマンスと圧縮率。

- lzop - 非常に優れたパフォーマンス、低圧縮率。

- gzip - 平均的なパフォーマンスと圧縮率。

- xz - パフォーマンスは低いが、圧縮率は最高。

- bzip2 - パフォーマンスが遅く、圧縮率も平均的です。互換性のために必要な場合のみ使用してください。

-

/etc/libvirt/qemu.confを保存して終了します。 virtqemudサービスを再起動します。# systemctl try-restart virtqemud

virsh managedsaveユーティリティーを使用して、仮想マシンの保存イメージを作成します。たとえば、次のコマンドは、仮想マシン demo-guest1 を停止し、その設定を保存します。

# virsh managedsave demo-guest1 Domain 'demo-guest1' saved by libvirt保存された仮想マシンファイルは、デフォルトで /var/lib/libvirt/qemu/save ディレクトリーに demo-guest1.save として置かれます。

- 次に仮想マシンを 起動 すると、上記のファイルから、保存された状態が自動的に復元します。

検証

管理保存が有効になっている仮想マシンを一覧表示します。以下の例では、saved として一覧表示されている仮想マシンで、管理保存が有効になっています。

# virsh list --managed-save --all Id Name State ---------------------------------------------------- - demo-guest1 saved - demo-guest2 shut off管理保存のイメージがある仮想マシンのリストを表示するには、次のコマンドを使用します。

# virsh list --with-managed-save --all Id Name State ---------------------------------------------------- - demo-guest1 shut off停止状態にある保存された仮想マシンのリストを表示するには、コマンドで

--allオプションまたは--inactiveオプションを使用する必要があります。

トラブルシューティング

- 保存した仮想マシンファイルが破損したり、読み込めない場合は、仮想マシンを復元すると、代わりに標準の仮想マシン起動が起動します。

10.3. コマンドラインを使用した仮想マシンの起動

コマンドライン (CLI) を使用して、シャットダウンした仮想マシン (VM) を起動したり、保存した仮想マシンを復元したりできます。CLI を使用すると、ローカル仮想マシンとリモート仮想マシンの両方を起動できます。

前提条件

- すでに定義されている非アクティブな仮想マシン

- 仮想マシンの名前

リモート仮想マシンの場合は、以下も設定されている。

- 仮想マシンが置かれているホストの IP アドレス

- ホストへの root アクセス権限

手順

ローカルの仮想マシンには、

virsh startユーティリティーを使用します。たとえば、次のコマンドは仮想マシン demo-guest1 を起動します。

# virsh start demo-guest1 Domain 'demo-guest1' startedリモートホストにある仮想マシンでは、ホストへの QEMU+SSH 接続と共に

virsh startユーティリティーを使用します。たとえば、次のコマンドは、ホスト 192.0.2.1 にある仮想マシン demo-guest1 を起動します。

# virsh -c qemu+ssh://root@192.0.2.1/system start demo-guest1 root@192.0.2.1's password: Domain 'demo-guest1' started

10.4. Web コンソールを使用した仮想マシンの起動

仮想マシンが 停止 状態にある場合は、RHEL 9 Web コンソールを使用して起動できます。ホストの起動時に、仮想マシンが自動的に起動するように設定することもできます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

- すでに定義されている非アクティブな仮想マシン

- 仮想マシンの名前

手順

インターフェイスで、起動する仮想マシンをクリックします。

選択した仮想マシンの詳細情報を含む新しいページが開き、仮想マシンのシャットダウンおよび削除を制御できます。

をクリックします。

仮想マシンが起動し、コンソールまたはグラフィカル出力に接続 できます。

オプション: ホスト起動時に仮想マシンが自動的に起動するように設定するには、Overview セクションの

Autostartチェックボックスを切り替えます。libvirt が管理していないネットワークインターフェイスを使用する場合は、systemd 設定も変更する必要があります。そうしないと、影響を受ける仮想マシンが起動できなくなる可能性があります。starting virtual machines automatically when the host starts を参照してください。

第11章 仮想マシンのクローン作成

特定のプロパティーセットで仮想マシンの新規作成を行うには、既存の仮想マシンの クローン を作成します。

クローンを作成すると、ストレージ用に独自のディスクイメージを使用する新しい仮想マシンが作成されますが、クローン設定と保存データのほとんどはソース仮想マシンと同じです。これにより、各仮想マシンを個別に最適化せずに、特定のタスクに最適化された複数の仮想マシンを準備できます。

11.1. 仮想マシンのクローン作成の仕組み

仮想マシンのクローンを作成すると、ソース仮想マシンとそのディスクイメージの XML 設定がコピーされるため、新しい仮想マシンの一意性を確保するように設定を調整します。これには、仮想マシンの名前を変更して、ディスクイメージのクローンを使用するようにすることが含まれます。ただし、クローンの仮想ディスクに保存されているデータは、ソース仮想マシンと同じです。

このプロセスは、新しい仮想マシンを作成してゲストオペレーティングシステムと一緒にインストールするよりも高速であり、特定の設定およびコンテンツを持つ仮想マシンを迅速に生成するために使用できます。

仮想マシンの複数のクローンを作成することを計画している場合は、最初に、以下を含まない仮想マシン テンプレート を作成します。

- 永続的なネットワーク MAC 設定などの一意の設定。これにより、クローンが適切に機能しなくなる可能性があります。

- SSH キーやパスワードファイルなどの機密データ。

手順は、Creating virtual machines templates を参照してください。

11.2. 仮想マシンテンプレートの作成

正常に機能する複数のクローン仮想マシンを作成するには、SSH 鍵や永続的なネットワーク MAC 設定などの、ソース仮想マシンに固有の情報および設定を削除します。これにより、仮想マシンのクローンを簡単かつ安全に作成するのに使用できる仮想マシンの テンプレート が得られます。

仮想マシンのテンプレートは、virt-sysprep ユーティリティーを使用して作成 することも、要件に基づいて 手動で作成 することもできます。

11.2.1. virt-sysprep を使用した仮想マシンテンプレートの作成

既存の仮想マシン (VM) から複製テンプレートを作成するには、virt-sysprep ユーティリティーを使用できます。これにより、特定のネットワーク設定やシステム登録メタデータなど、クローンが正しく機能しない可能性がある特定の設定が削除されます。その結果、virt-sysprep は仮想マシンのクローンをより効率的に作成し、クローンがより確実に動作するようにします。

前提条件

virt-sysprepユーティリティーを含むguestfs-toolsパッケージがホストにインストールされます。# dnf install guestfs-tools- テンプレートとして使用するソース仮想マシンがシャットダウンしている。

ソース仮想マシンのディスクイメージの場所を把握しており、その仮想マシンのディスクイメージファイルの所有者である。

libvirt の システムコネクション で作成した仮想マシンのディスクイメージが、デフォルトで

/var/lib/libvirt/imagesディレクトリーにあり、root ユーザーが所有している。# ls -la /var/lib/libvirt/images -rw-------. 1 root root 9665380352 Jul 23 14:50 a-really-important-vm.qcow2 -rw-------. 1 root root 8591507456 Jul 26 2017 an-actual-vm-that-i-use.qcow2 -rw-------. 1 root root 8591507456 Jul 26 2017 totally-not-a-fake-vm.qcow2 -rw-------. 1 root root 10739318784 Sep 20 17:57 another-vm-example.qcow2- オプション: ソース仮想マシンのディスク上の重要なデータがすべてバックアップされている。ソース仮想マシンをそのまま保持する場合は、クローン を作成してから、そのクローンをテンプレートに変換します。

手順

仮想マシンのディスクイメージの所有者としてログインしていることを確認します。

# whoami rootオプション: 仮想マシンのディスクイメージをコピーします。

# cp /var/lib/libvirt/images/a-really-important-vm.qcow2 /var/lib/libvirt/images/a-really-important-vm-original.qcow2これは後で、仮想マシンが正常にテンプレートに変換されたことを確認するために使用されます。

次のコマンドを使用し、/var/lib/libvirt/images/a-really-important-vm.qcow2 を、ソース仮想マシンのディスクイメージへのパスに置き換えます。

# virt-sysprep -a /var/lib/libvirt/images/a-really-important-vm.qcow2 [ 0.0] Examining the guest ... [ 7.3] Performing "abrt-data" ... [ 7.3] Performing "backup-files" ... [ 9.6] Performing "bash-history" ... [ 9.6] Performing "blkid-tab" ... [...]

検証

プロセスが成功したことを確認するには、変更したディスクイメージを元のイメージと比較します。次の例は、テンプレートの作成例を示しています。

# virt-diff -a /var/lib/libvirt/images/a-really-important-vm-orig.qcow2 -A /var/lib/libvirt/images/a-really-important-vm.qcow2 - - 0644 1001 /etc/group- - - 0000 797 /etc/gshadow- = - 0444 33 /etc/machine-id [...] - - 0600 409 /home/username/.bash_history - d 0700 6 /home/username/.ssh - - 0600 868 /root/.bash_history [...]

11.2.2. 仮想マシンテンプレートの手動による作成

既存の仮想マシンからテンプレートを作成する場合は、ゲスト仮想マシンを手動でリセットまたは設定解除して、クローン作成の準備をします。

前提条件

ソースの仮想マシンのディスクイメージの場所を把握しており、仮想マシンのディスクイメージファイルの所有者であることを確認します。

libvirt の システムコネクション で作成した仮想マシンのディスクイメージが、デフォルトで

/var/lib/libvirt/imagesディレクトリーにあり、root ユーザーが所有している。# ls -la /var/lib/libvirt/images -rw-------. 1 root root 9665380352 Jul 23 14:50 a-really-important-vm.qcow2 -rw-------. 1 root root 8591507456 Jul 26 2017 an-actual-vm-that-i-use.qcow2 -rw-------. 1 root root 8591507456 Jul 26 2017 totally-not-a-fake-vm.qcow2 -rw-------. 1 root root 10739318784 Sep 20 17:57 another-vm-example.qcow2- 仮想マシンがシャットダウンしていることを確認します。

- オプション: 仮想マシンのディスク上の重要なデータがすべてバックアップされている。ソースの仮想マシンをそのまま保持する場合は、クローン を作成してから、そのクローンを編集してテンプレートを作成します。

手順

クローンを作成するように仮想マシンを設定します。

- クローンに必要なソフトウェアをインストールします。

- オペレーティングシステムに一意でない設定を設定します。

- 固有でないアプリケーション設定を設定します。

ネットワーク設定を削除します。

以下のコマンドを使用して、永続的な udev ルールを削除します。

# rm -f /etc/udev/rules.d/70-persistent-net.rules注記udev ルールを削除しないと、最初の NIC の名前が

eth0ではなくeth1になる場合があります。/etc/NetworkManager/system-connections/ディレクトリーのNMConnectionファイルから一意の情報を削除します。MAC アドレス、IP アドレス、DNS、ゲートウェイ、およびその他の 一意 の情報または望ましくない設定を削除します。

*ID=ExampleNetwork BOOTPROTO="dhcp" HWADDR="AA:BB:CC:DD:EE:FF" <- REMOVE NM_CONTROLLED="yes" ONBOOT="yes" TYPE="Ethernet" UUID="954bd22c-f96c-4b59-9445-b39dd86ac8ab" <- REMOVE-

同様の 一意 の情報と望ましくない設定を

/etc/hostsおよび/etc/resolv.confファイルから削除します。

登録の詳細を削除します。

Red Hat ネットワーク (RHN) に登録されている仮想マシンの場合:

# rm /etc/sysconfig/rhn/systemidRed Hat Subscription Manager (RHSM) に登録されている仮想マシンの場合:

元の仮想マシンを使用しない場合は、次のコマンドを実行します。

# subscription-manager unsubscribe --all # subscription-manager unregister # subscription-manager clean元の仮想マシンを使用する場合は、以下を行います。

# subscription-manager clean注記元の RHSM プロファイルは、ID コードとともにポータルに残ります。クローンの作成後、次のコマンドを使用して仮想マシンで RHSM 登録を再アクティブ化します。

# subscription-manager register --consumerid=71rd64fx-6216-4409-bf3a-e4b7c7bd8ac9

その他の固有の詳細を削除します。

SSH 公開鍵と秘密鍵のペアを削除します。

# rm -rf /etc/ssh/ssh_host_exampleLVM デバイスの設定を削除します。

# rm /etc/lvm/devices/system.devices- 複数のマシンで実行している場合に、競合する可能性があるその他のアプリケーション固有の識別子や設定を削除します。

gnome-initial-setup-doneファイルを削除し、次回のシステムの起動時に設定ウィザードを実行するように仮想マシンを設定します。# rm ~/.config/gnome-initial-setup-done注記次回の起動時に実行するウィザードは、仮想マシンから削除された設定によって異なります。また、クローンの初回起動時には、ホスト名を変更することが推奨されます。

11.3. コマンドラインを使用した仮想マシンのクローン作成

テストのために、特定のプロパティーセットで新しい仮想マシンを作成するには、CLI を使用して既存の仮想マシンのクローンを作成します。

前提条件

- 移行元の仮想マシンがシャットダウンしている。

- クローンとして作成したディスクイメージを保存するのに十分なディスク領域があることを確認します。

- オプション: 仮想マシンのクローンを複数作成する場合は、クローンとして作成した仮想マシンが適切に動作するように、ソース仮想マシンから固有のデータと設定を削除します。手順は、仮想マシンテンプレートの作成 を参照してください。

手順

環境とユースケースに適したオプションを指定して

virt-cloneユーティリティーを使用します。サンプルのユースケース

次のコマンドは、

example-VM-1という名前のローカル仮想マシンのクローンを作成し、example-VM-1-clone仮想マシンを作成します。また、元の仮想マシンのディスクイメージと同じ場所に、同じデータでexample-VM-1-clone.qcow2ディスクイメージを作成して割り当てます。# virt-clone --original example-VM-1 --auto-clone Allocating 'example-VM-1-clone.qcow2' | 50.0 GB 00:05:37 Clone 'example-VM-1-clone' created successfully.次のコマンドは、

example-VM-2という名前で仮想マシンのクローンを作成し、example-VM-3という名前でローカル仮想マシンを作成します。この仮想マシンは、example-VM-2の複数ディスクのうち 2 つだけを使用します。# virt-clone --original example-VM-2 --name example-VM-3 --file /var/lib/libvirt/images/disk-1-example-VM-2.qcow2 --file /var/lib/libvirt/images/disk-2-example-VM-2.qcow2 Allocating 'disk-1-example-VM-2-clone.qcow2' | 78.0 GB 00:05:37 Allocating 'disk-2-example-VM-2-clone.qcow2' | 80.0 GB 00:05:37 Clone 'example-VM-3' created successfully.仮想マシンを別のホストにクローンするには、ローカルホストで定義を解除せずに仮想マシンを移行します。たとえば、次のコマンドは、以前に作成した仮想マシン

example-VM-3を192.0.2.1リモートシステムにローカルディスクを含めてクローンします。192.0.2.1に対して次のコマンドを実行するには root 権限が必要であることに注意してください。# virsh migrate --offline --persistent example-VM-3 qemu+ssh://root@192.0.2.1/system root@192.0.2.1's password: # scp /var/lib/libvirt/images/<disk-1-example-VM-2-clone>.qcow2 root@192.0.2.1/<user@remote_host.com>://var/lib/libvirt/images/ # scp /var/lib/libvirt/images/<disk-2-example-VM-2-clone>.qcow2 root@192.0.2.1/<user@remote_host.com>://var/lib/libvirt/images/

検証

仮想マシンのクローンが正常に作成され、正しく機能していることを確認するには、以下を行います。

クローンが、ホストの仮想マシンのリストに追加されていることを確認します。

# virsh list --all Id Name State --------------------------------------- - example-VM-1 shut off - example-VM-1-clone shut offクローンを起動し、起動しているかどうかを確認します。

# virsh start example-VM-1-clone Domain 'example-VM-1-clone' started

11.4. ウェブコンソールを使用して仮想マシンをクローンする

特定のプロパティーセットで新しい仮想マシンを作成するには、Web コンソールを使用して事前に設定した仮想マシンのクローンを作成します。

仮想マシンのクローンを作成すると、その仮想マシンに関連付けられたディスクのクローンも作成されます。

前提条件

- RHEL 9 Web コンソールがインストールされている。

- cockpit サービスが有効になっている。

ユーザーアカウントが Web コンソールにログインできる。

手順は、Web コンソールのインストールおよび有効化 を参照してください。

- Web コンソールの仮想マシンプラグインが システムにインストールされている。

- クローンを作成する仮想マシンがシャットダウンしていることを確認します。

手順

RHEL 9 Web コンソールにログインします。

詳細は、Web コンソールへのログイン を参照してください。

Web コンソールの仮想マシンインターフェイスで、クローンを作成する仮想マシンのメニューボタン をクリックします。

仮想マシン操作を制御するためのドロップダウンメニューが表示されます。

をクリックします。

仮想マシンのクローンの作成ダイアログが表示されます。

- オプション: 仮想マシンクローンの新しい名前を入力します。

をクリックします。

ソースの仮想マシンに基づいて、新しい仮想マシンが作成されます。

検証

- クローンとして作成された仮想マシンが、ホストで利用可能な仮想マシンのリストに表示されるかどうかを確認します。

第12章 仮想マシンの移行

仮想マシンの現在のホストが不安定な場合や使用できない場合や、ホストワークロードを再分散する場合は、仮想マシンを別の KVM ホストに移行できます。

12.1. 仮想マシンの移行の仕組み

ライブ マイグレーションを使用すると、ワークロードを中断することなく、わずかなダウンタイムのみで実行中の仮想マシン (VM) を移行できます。デフォルトでは移行された仮想マシンは、宛先ホスト上では一時的なもので、ソースホストでもそのまま定義されたままとなります。ライブ マイグレーションの重要な部分は、仮想マシンのメモリーと接続されている仮想化デバイスの状態を宛先ホストに転送することです。宛先ホストで仮想マシンが機能し続けるには、仮想マシンのディスクイメージが利用可能なままである必要があります。

シャットオフされた仮想マシンを移行するには、仮想マシンの設定を宛先ホストにコピーする オフライン マイグレーションを使用する必要があります。詳細は、以下の表を参照してください。

| 移行タイプ | 説明 | ユースケース | ストレージ要件 |

|---|---|---|---|

| ライブマイグレーション | 仮想マシンはソースホストマシンでそのまま実行を続け、KVM が仮想マシンのメモリーページを宛先ホストに転送します。移行がほぼ完了すると、KVM はごく短い間仮想マシンを中断し、宛先ホストで再開します。 | 常に稼働する必要がある仮想マシンに役に立ちます。ただし、I/O 負荷が高い仮想マシンなど、KVM がメモリーページを転送するよりも速くメモリーページを変更する仮想マシンの場合、ライブマイグレーションは失敗する可能性があります。(1) | 移行中、仮想マシンのディスクイメージに、ソースホストと宛先ホストの両方からアクセスできる必要があります。(2) |

| オフラインマイグレーション | 仮想マシンの設定を宛先ホストに移動します。 | シャットダウンした仮想マシンや、仮想マシンをシャットダウンしてもワークロードを中断しない場合に推奨されます。 | 仮想マシンのディスクイメージは、移行中にソースホストまたは宛先ホストからアクセスできる必要はなく、代わりに宛先ホストに手動でコピーまたは移動できます。 |

(1) 考えられる解決策については、以下を参照してください: ライブマイグレーションのための virsh migrate の 追加オプション

(2) これを実現するには、次のいずれかを使用します。

- 共有ネットワーク上 にあるストレージ

-

virsh migrateコマンドの--copy-storage-allパラメーターで、ネットワーク経由でソースから宛先にディスクイメージの内容をコピーします。 - ストレージエリアネットワーク (SAN) の論理ユニット (LUN)。

- Ceph Storage クラスター

大規模な移行をより簡単に管理するには、次のような他の Red Hat 製品を検討してください。

12.2. 仮想マシンの移行の利点

仮想マシンの移行は、以下の場合に役に立ちます。

- ロードバランシング

- ホストがオーバーロードするか、別のホストの使用率が低くなっている場合に、仮想マシンを使用率の低いホストマシンに移動できます。

- ハードウェアの非依存性

- ホストマシンでハードウェアデバイスのアップグレード、追加、削除などを行う必要がある場合は、仮想マシンをその他のホストに安全に移動できます。つまり、仮想マシンは、ハードウェアを改善する際にダウンタイムが生じることはありません。

- エネルギー節約

- 仮想マシンはその他のホストに再配布できるため、電力使用量の少ない時間帯に、アンロードしたホストシステムの電源を切ることで、節電やコスト削減が可能になります

- 地理的な移行

- 待ち時間の短縮や他の理由により、別の物理的な場所に仮想マシンを移動できます。

12.3. 仮想マシンの移行の制限事項

RHEL 9 で仮想マシンを移行する前に、移行の制限に注意してください。

特定の機能と設定を使用する仮想マシンは、移行すると正しく機能しなくなるか、移行が失敗します。このような機能は次のとおりです。

- デバイスパススルー

- SR-IOV デバイスの割り当て (Mellanox ネットワークデバイスの Virtual Function が接続された仮想マシンの移行 は正常に動作するため、例外となります)。

- vGPU などの仲介デバイス (NVIDIA vGPU が接続された仮想マシンの移行 は正常に動作するため、例外となります)。

- NUMA (Non-Uniform Memory Access) ピニングを使用するホスト間の移行は、ホストのトポロジーが類似している場合にのみ機能します。ただし、実行中のワークロードのパフォーマンスは、移行の影響を受ける可能性があります。

- ソースホストと宛先ホストの両方が、仮想マシン移行でサポートされる特定の RHEL バージョンを使用しています。仮想マシン移行でサポートされているホスト を参照してください。

ソース仮想マシンとターゲット仮想マシンの両方の物理 CPU は、同一である必要があります。そうでない場合、移行は失敗する可能性があります。以下の CPU 関連領域の仮想マシン間で相違があると、移行の問題が発生する可能性があります。

CPU モデル

- Intel 64 ホストと AMD64 ホスト間の移行は、x86-64 命令セットを共有している場合でもサポートされていません。

- 別の CPU モデルを持つホストに移行した後に仮想マシンが正しく機能することを確認する手順は、仮想マシン移行のためのホスト CPU の互換性の確認 を参照してください。

- 物理マシンのファームウェアバージョンと設定

12.4. コマンドラインを使用した仮想マシンの移行

仮想マシンの現在のホストが不安定な場合や使用できない場合や、ホストワークロードを再分散する場合は、仮想マシンを別の KVM ホストに移行できます。ライブマイグレーション または オフラインマイグレーション を実行できます。2 つのシナリオの違いについては、仮想マシンの移行の仕組み を参照してください。

前提条件

- ハイパーバイザー: ソースホストと宛先ホストの両方が KVM ハイパーバイザーを使用します。

-

ネットワーク接続: ソースホストと宛先ホストはネットワーク経由で相互にアクセスできます。

pingユーティリティーを使用してこれを確認します。 開いているポート: 宛先ホストで次のポートが開いていることを確認します。

- ポート 22 は、SSH を使用して宛先ホストに接続するために必要です。

- ポート 16514 は、TLS を使用して宛先ホストに接続するために必要です。

- ポート 16509 は、TCP を使用して宛先ホストに接続するために必要です。

- ポート 49152 - 49215 は、QEMU がメモリーおよびディスク移行データを転送するために必要です。

- ホスト: Red Hat が移行に対応できるようにするには、ソースホストと宛先ホストが特定のオペレーティングシステムとマシンタイプを使用している必要があります。これを確認するには、Supported hosts for virtual machine migration を参照してください。

- CPU: 仮想マシンは、宛先ホストの CPU 機能と互換性がある必要があります。これを確認するには、仮想マシン移行のホスト CPU の互換性の確認 を参照してください。

ストレージ: 移行される仮想マシンのディスクイメージは、ソースホストと宛先ホストの両方からアクセスできます。オフラインマイグレーションの場合は任意ですが、実行中の仮想マシンの移行に必要になります。両方のホストのストレージアクセスを確保するには、次のいずれかに該当している必要があります。

- ストレージエリアネットワーク (SAN) 論理ユニット (LUN) を使用している。

- Ceph Storage クラスター を使用している。

-

ソース仮想マシンディスクと同じ形式とサイズの ディスクイメージを作成済み で、仮想マシンを移行するときに

--copy-storage-allパラメーターを使用する。 - ディスクイメージが別のネットワーク上の場所にある。このような仮想マシンの共有ストレージを設定する手順は、Sharing virtual machine disk images with other hosts を参照してください。

ネットワーク帯域幅: 実行中の仮想マシンを移行する場合、ネットワーク帯域幅は仮想マシンがダーティーメモリーページを生成する速度を超える必要があります。

ライブマイグレーションを開始する前に仮想マシンのダーティーページ速度を取得するには、次の手順を実行します。

短期間、仮想マシンのダーティーページ生成速度を監視します。

# virsh domdirtyrate-calc <example_VM> 30監視が終了したら、結果を取得します。

# virsh domstats <example_VM> --dirtyrate Domain: 'example-VM' dirtyrate.calc_status=2 dirtyrate.calc_start_time=200942 dirtyrate.calc_period=30 dirtyrate.megabytes_per_second=2この例では、仮想マシンが 1 秒あたり 2MB のダーティーメモリーページを生成しています。帯域幅が 2MB/s 以下のネットワーク上でこのような仮想マシンをライブマイグレーションしようとすると、仮想マシンを一時停止したり、ワークロードを低くしたりしないと、ライブマイグレーションが進行しません。

ライブマイグレーションが正常に終了するように、Red Hat では、ネットワークの帯域幅が仮想マシンのダーティーページの生成速度を大幅に上回ることを推奨しています。

注記calc_periodオプションの値は、ワークロードとダーティーページ速度により異なる場合があります。いくつかのcalc_period値を試して、環境のダーティーページ速度に合わせた最適な期間を決定できます。

- ブリッジタップネットワークの詳細: パブリックブリッジタップネットワーク内の既存の仮想マシンを移行する場合、ソースホストと宛先ホストは同じネットワーク上に配置されている必要があります。そうでない場合は、移行後に仮想マシンのネットワークが機能しなくなります。

接続プロトコル: 仮想マシンの移行を実行する場合、ソースホスト上の

virshクライアントは、いくつかのプロトコルのいずれかを使用して、宛先ホスト上の libvirt デーモンに接続できます。次の手順の例では SSH 接続を使用していますが、別の接続を選択することもできます。libvirt で SSH 接続を使用する場合は、

virtqemudソケットが有効になっていて、宛先ホストで実行されていることを確認してください。# systemctl enable --now virtqemud.socketlibvirt で TLS 接続を使用する場合は、

virtproxyd-tlsソケットが有効になっていて、宛先ホストで実行していることを確認してください。# systemctl enable --now virtproxyd-tls.socketlibvirt で TCP 接続を使用する場合は、

virtproxyd-tcpソケットが有効になっていて、宛先ホストで実行していることを確認してください。# systemctl enable --now virtproxyd-tcp.socket

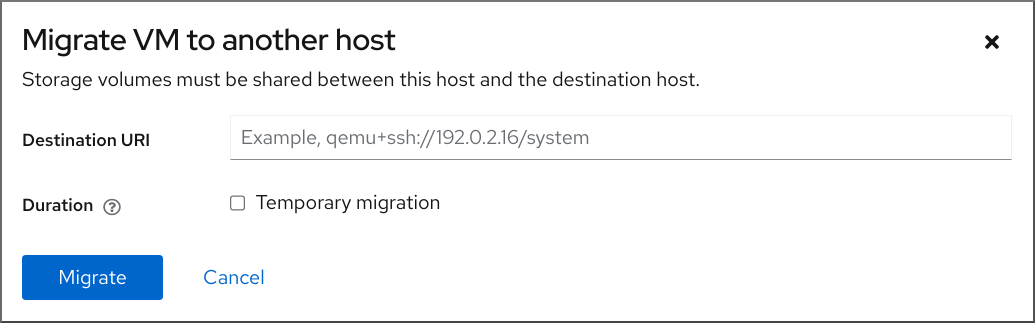

手順

仮想マシンをあるホストから別のホストに移行するには、virsh migrate コマンドを使用します。

オフラインマイグレーション

次のコマンドは、SSH トンネルを使用して、シャットオフされた

example-VM仮想マシンをローカルホストからexample-destinationホストのシステム接続に移行します。# virsh migrate --offline --persistent <example_VM> qemu+ssh://example-destination/system

ライブマイグレーション

次のコマンドは、SSH トンネルを使用して、

example-VM仮想マシンをローカルホストからexample-destinationホストのシステム接続に移行します。仮想マシンは移行中も稼働し続けます。# virsh migrate --live --persistent <example_VM> qemu+ssh://example-destination/system移行が完了するまで待ちます。ネットワーク帯域幅、システム負荷、仮想マシンのサイズによっては、このプロセスに時間がかかる場合があります。

virsh migrateで--verboseオプションが使用されていないと、CLI はエラー以外の進捗インジケーターを表示しません。移行中は、

virsh domjobinfoユーティリティーを使用して移行の統計を表示できます。

マルチ FD ライブマイグレーション

ライブマイグレーション中に、宛先ホストへの複数の並列接続を使用できます。これは、複数のファイル記述子 (マルチ FD) マイグレーションとも呼ばれます。マルチ FD 移行では、移行プロセスに利用可能なネットワーク帯域幅をすべて利用することで、移行を高速化できます。

# virsh migrate --live --persistent --parallel --parallel-connections 4 <example_VM> qemu+ssh://<example-destination>/systemこの例では、4 つのマルチ FD チャネルを使用して <example_VM> 仮想マシンを移行します。利用可能なネットワーク帯域幅 10 Gbps ごとに 1 つのチャネルを使用することを推奨します。デフォルト値は 2 チャネルです。

ダウンタイム制限を延長したライブマイグレーション

ライブマイグレーション中に仮想マシンを一時停止できる最大時間 (ミリ秒単位) を指定する

maxdowntimeパラメーターを設定することで、ライブマイグレーションの信頼性を向上できます。ダウンタイムを長く設定すると、マイグレーションが正常に完了するようになります。# virsh migrate-setmaxdowntime <example_VM> <time_interval_in_milliseconds>

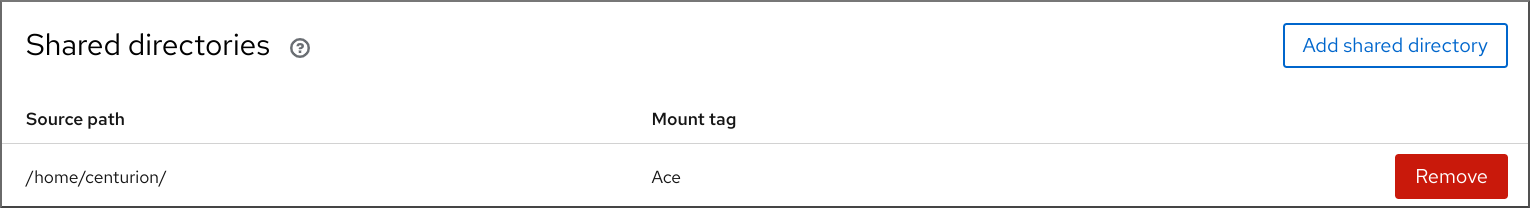

パスワードなし SSH 認証によるライブマイグレーション