Serverless のインストール

Serverless Operator、Knative CLI、Knative Serving、および Knative Eventing のインストール

概要

第1章 OpenShift Serverless のインストールの準備

OpenShift Serverless をインストールする前に、サポートされる設定および前提条件に関する以下の情報を確認してください。

OpenShift Container Platform の場合:

- OpenShift Serverless は、ネットワークが制限された環境でのインストールに対してサポートされません。

- 現時点で、OpenShift Serverless は単一クラスター上でのマルチテナント設定で使用することはできません。

1.1. サポートされる構成

OpenShift Serverless (最新バージョンおよび以前のバージョン) のサポートされる機能、設定、および統合のセットは、サポートされる設定 ページで確認できます。

1.2. OpenShift Container Platform でのスケーラビリティーおよびパフォーマンス

OpenShift Serverless は、3 つのメインノードと 3 つのワーカーノードの設定でテストされています。各ノードには、64 個の CPU、457 GB のメモリー、および 394 GB のストレージがあります。

この設定を使用して作成できる Knative サービスの最大数は 3,000 です。これは、OpenShift Container Platform の Kubernetes サービスの制限である 10,000 に相当します。これは、1 つの Knative サービスが 3 つの Kubernetes サービスを作成するためです。

ゼロ応答時間からの平均スケールは約 3.4 秒で、最大応答時間は 8 秒で、単純な Quarkus アプリケーションの 99.9 パーセンタイルは 4.5 秒でした。これらの時間は、アプリケーションとアプリケーションの実行時間によって異なる場合があります。

クラスターサイズ要件の定義に関する次のセクションは、これらのディストリビューションに適用されます。

- OpenShift Container Platform

- OpenShift Dedicated

- Red Hat OpenShift Service on AWS

1.3. クラスターサイズ要件の定義

OpenShift Serverless をインストールして使用するには、クラスターのサイズを適切に設定する必要があります。

以下の要件は、クラスターのワーカーマシンのプールだけを対象とします。コントロールプレーンは一般的なスケジューリングには使用されず、要件から省略されます。

OpenShift Serverless を使用する最小要件は、10 CPU および 40GB メモリーを持つクラスターです。デフォルトで、各 Pod は CPU ~400m を要求し、推奨値のベースはこの値になります。

OpenShift Serverless を実行するために必要な総サイズは、インストールされているコンポーネントとデプロイされているアプリケーションに依存し、デプロイメントによって異なる場合があります。

1.4. OpenShift Container Platform でコンピュートマシンセットを使用したクラスターのスケーリング

OpenShift Container Platform MachineSet API を使用して、クラスターを必要なサイズに手動でスケールアップすることができます。最小要件は、通常 2 つのマシンを追加することによってデフォルトのコンピュートマシンセットのいずれかをスケールアップする必要があることを意味します。コンピューティングマシンセットの手動スケーリング を参照してください。

1.4.1. 高度なユースケースの追加要件

OpenShift Container Platform でのロギングまたはメータリングなどの高度なユースケースの場合は、追加のリソースをデプロイする必要があります。このようなユースケースで推奨される要件は 24 vCPU および 96GB メモリーです。

クラスターで高可用性 (HA) を有効にしている場合、これには Knative Serving コントロールプレーンの各レプリカについて 0.5 - 1.5 コアおよび 200MB - 2GB のメモリーが必要です。HA は、デフォルトで一部の Knative Serving コンポーネントについて有効になります。高可用性コンポーネントレプリカの設定のドキュメントに従って HA を無効にできます。

第2章 OpenShift Serverless Operator のインストール

OpenShift Serverless Operator をインストールすると、OpenShift Container Platform クラスターに Knative Serving、Knative Eventing、および Apache Kafka 用の Knative ブローカーをインストールし、使用できます。OpenShift Serverless Operator は、クラスターの Knative カスタムリソース定義 (CRD) を管理し、各コンポーネントの個別の Config Map を直接修正することなくそれらを設定できるようにします。

2.1. OpenShift Serverless Operator のリソース要件

次のサンプル設定は、OpenShift Serverless Operator インストールの最小リソース要件を想定する場合に役立ちます。具体的な要件は大幅に異なる可能性があり、OpenShift Serverless の使用が増えるにつれて大きくなる可能性があります。

サンプル設定で使用されるテストスイートには、次のパラメーターがあります。

以下の設定を含む OpenShift Container Platform クラスター

- 10 ワーカー (8 vCPU、16 GiB メモリー)

- Kafka 専用のワーカー 3 つ

- Prometheus 専用のワーカー 2 つ

- Serverless とテストのデプロイメントの両方に残りのワーカー 5 つ

- 主にコントロールプレーンの使用に重点を置いた、並行して実行される 89 のテストシナリオ。テストシナリオでは通常、Knative サービスが、インメモリーチャネル、Kafka チャネル、インメモリーブローカー、または Kafka ブローカーを介して、デプロイメントまたは Knative サービスにイベントを送信します。

- テストシナリオが繰り返し削除され、再作成される 48 の再作成シナリオ。

- 41 の安定したシナリオでは、テスト実行全体を通じてイベントがゆっくりと継続的に送信されます。

テストの設定には、合計で次のものが含まれます。

- 170 Knative サービス

- 20 個のインメモリーチャネル

- 24 個の Kafka チャネル

- 52 のサブスクリプション

- 42 のブローカー

- 68 のトリガー

次の表は、テストスイートによって検出された高可用性 (HA) セットアップの最小リソース要件の詳細を示しています。

| コンポーネント | RAM リソース | CPU リソース |

|---|---|---|

| OpenShift Serverless Operator | 1 GB | 0.2 コア |

| Knative Serving | 5GB | 2.5 コア |

| Knative Eventing | 2 GB | 0.5 コア |

| Knative broker for Apache Kafka | 6GB | 1 コア |

| 合計 | 14 GB | 4.2 コア |

次の表は、テストスイートによって検出された非 HA セットアップの最小リソース要件の詳細を示しています。

| コンポーネント | RAM リソース | CPU リソース |

|---|---|---|

| OpenShift Serverless Operator | 1 GB | 0.2 コア |

| Knative Serving | 2.5 GB | 1.2 コア |

| Knative Eventing | 1 GB | 0.2 コア |

| Knative broker for Apache Kafka | 6GB | 1 コア |

| 合計 | 10.5GB | 2.6 コア |

2.2. Web コンソールからの OpenShift Serverless Operator のインストール

OpenShift Container Platform Web コンソールを使用して、OperatorHub から OpenShift Serverless Operator をインストールできます。この Operator をインストールすると、Knative コンポーネントをインストールして使用できるようになります。

前提条件

- OpenShift Container Platform に対するクラスター管理者権限があるか、Red Hat OpenShift Service on AWS または OpenShift Dedicated に対するクラスターまたは専用管理者権限がある。

- OpenShift Container Platform の場合は、クラスターで Marketplace 機能が有効になっているか、Red Hat Operator カタログソースが手動で設定されている。

- Web コンソールにログインしている。

手順

- Web コンソールで、Operators → OperatorHub ページに移動します。

- スクロールするか、またはこれらのキーワード Serverless を Filter by keyword ボックス に入力して OpenShift Serverless Operator を検索します。

- Operator についての情報を確認してから、Install をクリックします。

Install Operator ページで以下を行います。

-

Installation Mode は All namespaces on the cluster (default) になります。このモードは、デフォルトの

openshift-serverlessnamespace で Operator をインストールし、クラスターのすべての namespace を監視し、Operator をこれらの namespace に対して利用可能にします。 -

Installed Namespace は

openshift-serverlessです。 Update Channel を選択します。

- stable チャネルは、OpenShift Serverless Operator の最新の安定したリリースのインストールを可能にします。stable チャネルがデフォルトです。

- 別のバージョンをインストールするには、対応する stable-x.y チャネル (たとえば、stable-1.29) を指定します。

- Update Channel として stable チャネルを選択します。stable チャネルは、OpenShift Serverless Operator の最新の安定したリリースのインストールを可能にします。

- Automatic または Manual 承認ストラテジーを選択します。

-

Installation Mode は All namespaces on the cluster (default) になります。このモードは、デフォルトの

- Install をクリックし、Operator をこの OpenShift Container Platform クラスターの選択した namespace で利用可能にします。

Catalog → Operator Management ページから、OpenShift Serverless Operator サブスクリプションのインストールおよびアップグレードの進捗をモニターできます。

- 手動 の承認ストラテジーを選択している場合、サブスクリプションのアップグレードステータスは、その Install Plan を確認し、承認するまで Upgrading のままになります。Install Plan ページでの承認後に、サブスクリプションのアップグレードステータスは Up to date に移行します。

- 自動 の承認ストラテジーを選択している場合、アップグレードステータスは、介入なしに Up to date に解決するはずです。

検証

サブスクリプションのアップグレードステータスが Up to date に移行したら、Catalog → Installed Operators を選択し、OpenShift Serverless Operator が表示され、その Status が最終的に関連する namespace で InstallSucceeded に解決することを確認します。

上記通りにならない場合:

- Catalog → Operator Management ページに切り替え、Operator Subscriptions および Install Plans タブで Status の下の失敗またはエラーの有無を確認します。

-

さらにトラブルシューティングを行うために、Workloads → Pods ページで問題を報告している

openshift-serverlessプロジェクト内の Pod のログを確認します。

OpenShift Serverless で Red Hat 分散トレースを使用する 場合は、KnativeServing または KnativeEventing をインストールする前に、Red Hat 分散トレースをインストールして設定する必要があります。

2.3. CLI からの OpenShift Serverless Operator のインストール

CLI を使用して、OperatorHub から OpenShift Serverless Operator をインストールできます。この Operator をインストールすると、Knative コンポーネントをインストールして使用できるようになります。

前提条件

- OpenShift Container Platform に対するクラスター管理者権限があるか、Red Hat OpenShift Service on AWS または OpenShift Dedicated に対するクラスターまたは専用管理者権限がある。

- OpenShift Container Platform の場合は、クラスターで Marketplace 機能が有効になっているか、Red Hat Operator カタログソースが手動で設定されている。

- クラスターにログインしている。

手順

Namespace、OperatorGroup、およびSubscriptionオブジェクトを含む YAML ファイルを作成して、namespace を OpenShift Serverless Operator にサブスクライブします。たとえば、次の内容でファイルserverless-subscription.yamlを作成します。Subscription の例

Copy to Clipboard Copied! Toggle word wrap Toggle overflow - 1

- Operator のチャネル名。

stableチャネルを使用すると、OpenShift Serverless Operator の最新の安定したバージョンをインストールできます。別のバージョンをインストールするには、対応するstable-x.yチャネル (たとえば、stable-1.29) を指定します。 - 2

- サブスクライブする Operator の名前。OpenShift Serverless Operator の場合、これは常に

serverless-operatorです。 - 3

- Operator を提供する CatalogSource の名前。デフォルトの OperatorHub カタログソースには

redhat-operatorsを使用します。 - 4

- CatalogSource の namespace。デフォルトの OperatorHub カタログソースには

openshift-marketplaceを使用します。

Subscriptionオブジェクトを作成します。oc apply -f serverless-subscription.yaml

$ oc apply -f serverless-subscription.yamlCopy to Clipboard Copied! Toggle word wrap Toggle overflow

検証

クラスターサービスバージョン (CSV) が Succeeded フェーズに達したことを確認します。

コマンドの例

$ oc get csv

$ oc get csv出力例

NAME DISPLAY VERSION REPLACES PHASE serverless-operator.v1.25.0 Red Hat OpenShift Serverless 1.25.0 serverless-operator.v1.24.0 Succeeded

NAME DISPLAY VERSION REPLACES PHASE

serverless-operator.v1.25.0 Red Hat OpenShift Serverless 1.25.0 serverless-operator.v1.24.0 SucceededOpenShift Serverless で Red Hat 分散トレースを使用する 場合は、KnativeServing または KnativeEventing をインストールする前に、Red Hat 分散トレースをインストールして設定する必要があります。

2.4. グローバル設定

OpenShift Serverless Operator は、KnativeServing および KnativeEventing カスタムリソースからシステムの Config Map への値の反映を含む Knative インストールのグローバル設定を管理します。手動で適用される Config Map の更新は Operator によって上書きされます。ただし、Knative カスタムリソースを変更すると、これらの Config Map の値を設定できます。

Knative には、名前に接頭辞 config- が付けられた複数の Config Map があります。すべての Knative Config Map は、適用するカスタムリソースと同じ namespace に作成されます。たとえば、KnativeServing カスタムリソースが knative-serving namespace に作成される場合は、すべての Knative Serving Config Map もこの namespace に作成されます。

Knative カスタムリソースの spec.config には、Config Map ごとに config-<name> という名前の <name> エントリーが 1 つあり、Config Map data で使用される値を持ちます。

2.6. 次のステップ

- OpenShift Serverless Operator のインストール後に、Knative Serving をインストールするか、Knative Eventing をインストールする ことができます。

第3章 Knative CLI のインストール

Knative (kn) CLI には、独自のログインメカニズムがありません。クラスターにログインするには、OpenShift (oc) CLI をインストールし、oc login コマンドを使用する必要があります。CLI のインストールオプションは、オペレーティングシステムによって異なる場合があります。

ご使用のオペレーティングシステム用に OpenShift CLI (oc) をインストールする方法および oc でのログイン方法の詳細は、OpenShift CLI の使用開始 に関するドキュメントを参照してください。

Knative (kn) CLI を使用して OpenShift Serverless をインストールすることはできません。クラスター管理者は、OpenShift Serverless Operator のインストール のドキュメントで説明されているように、OpenShift Serverless Operator をインストールし、Knative コンポーネントをセットアップする必要があります。

新しい OpenShift Serverless リリースで古いバージョンの Knative (kn) CLI の使用を試行する場合は、API が見つからないとエラーが発生します。

たとえば、バージョン 1.2 を使用する Knative (kn) CLI の 1.23.0 リリースと、Knative Serving および Knative Eventing API の 1.3 バージョンを使用する 1.24.0 OpenShift Serverless リリースを使用する場合、CLI は古い 1.2 API バージョンを探し続けるため、機能しません。

問題を回避するために、OpenShift Serverless リリースの最新の Knative (kn) CLI バージョンを使用していることを確認してください。

3.1. OpenShift Container Platform Web コンソールを使用した Knative CLI のインストール

OpenShift Container Platform Web コンソールを使用すると、Knative (kn) CLI をインストールするための合理化された直感的なユーザーインターフェイスが提供されます。OpenShift Serverless Operator をインストールすると、OpenShift Container PlatformWeb コンソールの コマンドラインツール ページから Linux (amd64、s390x、ppc64le)、macOS、または Windows 用の Knative (kn) CLI をダウンロードするためのリンクが表示されます。

前提条件

- OpenShift Container Platform Web コンソールにログインしている。

OpenShift Serverless Operator および Knative Serving が OpenShift Container Platform クラスターにインストールされている。

重要libc が利用できない場合は、CLI コマンドの実行時に以下のエラーが表示される場合があります。

kn: No such file or directory

$ kn: No such file or directoryCopy to Clipboard Copied! Toggle word wrap Toggle overflow -

この手順の検証手順を使用する場合は、OpenShift (

oc) CLI をインストールする必要がある。

手順

-

Command Line Tools ページから Knative (

kn) CLI をダウンロードします。Command Line Tools ページには、Web コンソールの右上の アイコンをクリックして、リストの Command Line Tools を選択します。

アイコンをクリックして、リストの Command Line Tools を選択します。

アーカイブを展開します。

tar -xf <file>

$ tar -xf <file>Copy to Clipboard Copied! Toggle word wrap Toggle overflow -

knバイナリーをPATHにあるディレクトリーに移動します。 PATHを確認するには、以下を実行します。echo $PATH

$ echo $PATHCopy to Clipboard Copied! Toggle word wrap Toggle overflow

検証

以下のコマンドを実行して、正しい Knative CLI リソースおよびルートが作成されていることを確認します。

oc get ConsoleCLIDownload

$ oc get ConsoleCLIDownloadCopy to Clipboard Copied! Toggle word wrap Toggle overflow 出力例

NAME DISPLAY NAME AGE kn kn - OpenShift Serverless Command Line Interface (CLI) 2022-09-20T08:41:18Z oc-cli-downloads oc - OpenShift Command Line Interface (CLI) 2022-09-20T08:00:20Z

NAME DISPLAY NAME AGE kn kn - OpenShift Serverless Command Line Interface (CLI) 2022-09-20T08:41:18Z oc-cli-downloads oc - OpenShift Command Line Interface (CLI) 2022-09-20T08:00:20ZCopy to Clipboard Copied! Toggle word wrap Toggle overflow oc get route -n openshift-serverless

$ oc get route -n openshift-serverlessCopy to Clipboard Copied! Toggle word wrap Toggle overflow 出力例

NAME HOST/PORT PATH SERVICES PORT TERMINATION WILDCARD kn kn-openshift-serverless.apps.example.com knative-openshift-metrics-3 http-cli edge/Redirect None

NAME HOST/PORT PATH SERVICES PORT TERMINATION WILDCARD kn kn-openshift-serverless.apps.example.com knative-openshift-metrics-3 http-cli edge/Redirect NoneCopy to Clipboard Copied! Toggle word wrap Toggle overflow

3.2. RPM パッケージマネージャーを使用した Linux 用の Knative CLI のインストール

Red Hat Enterprise Linux (RHEL) の場合、yum や dnf などのパッケージマネージャーを使用して、Knative (kn) CLI を RPM としてインストールできます。これにより、Knative CLI バージョンをシステムで自動的に管理できます。たとえば、dnf upgrade のようなコマンドを使用すると、新しいバージョンが利用可能な場合は、kn を含むすべてのパッケージがアップグレードされます。

前提条件

- お使いの Red Hat アカウントに有効な OpenShift Container Platform サブスクリプションがある。

手順

Red Hat Subscription Manager に登録します。

subscription-manager register

# subscription-manager registerCopy to Clipboard Copied! Toggle word wrap Toggle overflow 最新のサブスクリプションデータをプルします。

subscription-manager refresh

# subscription-manager refreshCopy to Clipboard Copied! Toggle word wrap Toggle overflow 登録済みのシステムにサブスクリプションを添付します。

subscription-manager attach --pool=<pool_id>

# subscription-manager attach --pool=<pool_id>1 Copy to Clipboard Copied! Toggle word wrap Toggle overflow - 1

- 有効な OpenShift Container Platform サブスクリプションのプール ID

Knative (

kn) CLI に必要なリポジトリーを有効にします。Linux (x86_64, amd64)

subscription-manager repos --enable="openshift-serverless-1-for-rhel-8-x86_64-rpms"

# subscription-manager repos --enable="openshift-serverless-1-for-rhel-8-x86_64-rpms"Copy to Clipboard Copied! Toggle word wrap Toggle overflow Linux on IBM zSystems および IBM® LinuxONE (s390x)

subscription-manager repos --enable="openshift-serverless-1-for-rhel-8-s390x-rpms"

# subscription-manager repos --enable="openshift-serverless-1-for-rhel-8-s390x-rpms"Copy to Clipboard Copied! Toggle word wrap Toggle overflow Linux on IBM Power (ppc64le)

subscription-manager repos --enable="openshift-serverless-1-for-rhel-8-ppc64le-rpms"

# subscription-manager repos --enable="openshift-serverless-1-for-rhel-8-ppc64le-rpms"Copy to Clipboard Copied! Toggle word wrap Toggle overflow

パッケージマネージャーを使用して、Knative (

kn) CLI を RPM としてインストールします。yumコマンドの例yum install openshift-serverless-clients

# yum install openshift-serverless-clientsCopy to Clipboard Copied! Toggle word wrap Toggle overflow

3.3. RPM パッケージマネージャーとともにインストールされる Knative CLI のロックバージョン

最新ではなく、メンテナンスフェーズにある Knative (kn) CLI バージョンの使用が必要になる場合があります。これを実現するには、kn のバージョンをロックしてアップグレードできないようにします。

手順

DNF パッケージマネージャーの

versionlockプラグインをインストールします。dnf install 'dnf-command(versionlock)'

# dnf install 'dnf-command(versionlock)'Copy to Clipboard Copied! Toggle word wrap Toggle overflow 次のコマンドを実行して、

knのバージョンをロックします。dnf versionlock add --raw 'openshift-serverless-clients-1.7.*'

# dnf versionlock add --raw 'openshift-serverless-clients-1.7.*'Copy to Clipboard Copied! Toggle word wrap Toggle overflow このコマンドは、

knを Knative 1.7 に基づくバージョンにロックします。Knative 1.7 は、OpenShift Serverless 1.29 のリリース時にメンテナンスフェーズにありました。

3.4. ロックされたバージョンでの Knative CLI のアップグレード

以前にバージョンがロックされていた Knative (kn) CLI バージョンを手動でアップグレードできます。

手順

アップグレードされたパッケージが利用可能かどうかを確認します。

dnf search --showduplicates openshift-serverless-clients

# dnf search --showduplicates openshift-serverless-clientsCopy to Clipboard Copied! Toggle word wrap Toggle overflow -

knのバージョンロックを削除します。

dnf versionlock delete openshift-serverless-clients

# dnf versionlock delete openshift-serverless-clients-

新しいバージョンに

knをロックします。

dnf versionlock add --raw 'openshift-serverless-clients-1.8.*'

# dnf versionlock add --raw 'openshift-serverless-clients-1.8.*'

+ この例では、Knative 1.8 に基づく kn バージョンを使用します。

新しい利用可能なバージョンにアップグレードします。

dnf install --upgrade openshift-serverless-clients

# dnf install --upgrade openshift-serverless-clientsCopy to Clipboard Copied! Toggle word wrap Toggle overflow

3.5. Linux の Knative CLI のインストール

RPM または別のパッケージマネージャーがインストールされていない Linux ディストリビューションを使用している場合は、Knative (kn) CLI をバイナリーファイルとしてインストールできます。これを行うには、tar.gz アーカイブをダウンロードして解凍し、バイナリーを PATH のディレクトリーに追加する必要があります。

前提条件

RHEL または Fedora を使用していない場合は、ライブラリーパスのディレクトリーに libc がインストールされていることを確認してください。

重要libc が利用できない場合は、CLI コマンドの実行時に以下のエラーが表示される場合があります。

kn: No such file or directory

$ kn: No such file or directoryCopy to Clipboard Copied! Toggle word wrap Toggle overflow

手順

Knative (

kn) CLI のtar.gzアーカイブをダウンロードします。また、Serverless クライアントダウンロードミラー 内のそのバージョンに対応するディレクトリーに移動して、任意のバージョンの

knをダウンロードすることもできます。アーカイブを展開します。

tar -xf <filename>

$ tar -xf <filename>Copy to Clipboard Copied! Toggle word wrap Toggle overflow -

knバイナリーをPATHにあるディレクトリーに移動します。 PATHを確認するには、以下を実行します。echo $PATH

$ echo $PATHCopy to Clipboard Copied! Toggle word wrap Toggle overflow

3.6. macOS の Knative CLI のインストール

macOS を使用している場合は、Knative (kn) CLI をバイナリーファイルとしてインストールできます。これを行うには、tar.gz アーカイブをダウンロードして解凍し、バイナリーを PATH のディレクトリーに追加する必要があります。

手順

Knative (

kn)CLItar.gzアーカイブ をダウンロードします。また、Serverless クライアントダウンロードミラー 内のそのバージョンに対応するディレクトリーに移動して、任意のバージョンの

knをダウンロードすることもできます。- アーカイブを解凍して解凍します。

-

knバイナリーをPATHにあるディレクトリーに移動します。 PATHを確認するには、ターミナルウィンドウを開き、以下を実行します。echo $PATH

$ echo $PATHCopy to Clipboard Copied! Toggle word wrap Toggle overflow

3.7. Windows の Knative CLI のインストール

Windows を使用している場合は、Knative (kn) CLI をバイナリーファイルとしてインストールできます。これを行うには、ZIP アーカイブをダウンロードして解凍し、バイナリーを PATH のディレクトリーに追加する必要があります。

手順

Knative (

kn) CLIZIP アーカイブ をダウンロードします。また、Serverless クライアントダウンロードミラー 内のそのバージョンに対応するディレクトリーに移動して、任意のバージョンの

knをダウンロードすることもできます。- ZIP プログラムでアーカイブを展開します。

-

knバイナリーをPATHにあるディレクトリーに移動します。 PATHを確認するには、コマンドプロンプトを開いて以下のコマンドを実行します。path

C:\> pathCopy to Clipboard Copied! Toggle word wrap Toggle overflow

第4章 Knative Serving のインストール

Knative Serving をインストールすると、クラスター上で Knative サービスや関数を作成できます。また、オートスケーリングやネットワークオプションなどの追加機能をアプリケーションに利用することも可能です。

OpenShift Serverless Operator をインストールした後、デフォルト設定を使用して Knative Serving をインストールすることも、KnativeServing カスタムリソース (CR) でより詳細な設定を設定することもできます。KnativeServing CR の設定オプションの詳細については、グローバル設定を参照してください。

OpenShift Serverless で Red Hat 分散トレースを使用する 場合は、KnativeServing をインストールする前に、Red Hat 分散トレースをインストールして設定する必要があります。

4.1. Web コンソールを使用した Knative Serving のインストール

OpenShift Serverless Operator をインストールした後、OpenShift Container Platform の Web コンソールを使用して Knative Serving をインストールします。デフォルトの設定を使用して Knative Serving をインストールすることも、KnativeServing カスタムリソース (CR) でより詳細な設定を設定することもできます。

前提条件

- OpenShift Container Platform に対するクラスター管理者権限があるか、Red Hat OpenShift Service on AWS または OpenShift Dedicated に対するクラスターまたは専用管理者権限がある。

- OpenShift Container Platform Web コンソールにログインしている。

- OpenShift Serverless Operator がインストールされている。

手順

- OpenShift Container Platform Web コンソールの Administrator パースペクティブで、Operators → Installed Operators に移動します。

- ページ上部の Project ドロップダウンメニューが Project: knative-serving に設定されていることを確認します。

- OpenShift Serverless Operator の Provided API 一覧で Knative Serving をクリックし、Knative Serving タブに移動します。

- Create Knative Serving をクリックします。

Create Knative Serving ページで、Create をクリックしてデフォルト設定を使用し、Knative Serving をインストールできます。

また、Knative Serving インストールの設定を変更するには、提供されるフォームを使用するか、YAML を編集して

KnativeServingオブジェクトを編集します。-

KnativeServingオブジェクト作成を完全に制御する必要がない単純な設定には、このフォームの使用が推奨されます。 KnativeServingオブジェクトの作成を完全に制御する必要のあるより複雑な設定には、YAML の編集が推奨されます。YAML にアクセスするには、Create Knative Serving ページの右上にある edit YAML リンクをクリックします。フォームを完了するか、YAML の変更が完了したら、Create をクリックします。

注記KnativeServing カスタムリソース定義の設定オプションの詳細は、高度なインストール設定オプション に関するドキュメントを参照してください。

-

-

Knative Serving のインストール後に、

KnativeServingオブジェクトが作成され、Knative Serving タブに自動的にダイレクトされます。リソースの一覧にknative-servingカスタムリソースが表示されます。

検証

-

Knative Serving タブで

knative-servingカスタムリソースをクリックします。 Knative Serving Overview ページに自動的にダイレクトされます。

- スクロールダウンして、Conditions のリストを確認します。

ステータスが True の条件のリストが表示されます (例のイメージを参照)。

注記

注記Knative Serving リソースが作成されるまでに数分の時間がかかる場合があります。Resources タブでステータスを確認できます。

- 条件のステータスが Unknown または False である場合は、しばらく待ってから、リソースが作成されたことを再度確認します。

4.2. YAML を使用した Knative Serving のインストール

OpenShift Serverless Operator をインストールした後、デフォルト設定を使用して Knative Serving をインストールすることも、KnativeServing カスタムリソース (CR) でより詳細な設定を設定することもできます。YAML ファイルと oc CLI を利用して、以下の手順で Knative Serving をインストールすることができます。

前提条件

- OpenShift Container Platform に対するクラスター管理者権限があるか、Red Hat OpenShift Service on AWS または OpenShift Dedicated に対するクラスターまたは専用管理者権限がある。

- OpenShift Serverless Operator がインストールされている。

-

OpenShift CLI (

oc) がインストールされている。

手順

serving.yamlという名前のファイルを作成し、以下の YAML サンプルをこれにコピーします。apiVersion: operator.knative.dev/v1beta1 kind: KnativeServing metadata: name: knative-serving namespace: knative-servingapiVersion: operator.knative.dev/v1beta1 kind: KnativeServing metadata: name: knative-serving namespace: knative-servingCopy to Clipboard Copied! Toggle word wrap Toggle overflow serving.yamlファイルを適用します。oc apply -f serving.yaml

$ oc apply -f serving.yamlCopy to Clipboard Copied! Toggle word wrap Toggle overflow

検証

インストールが完了したことを確認するには、以下のコマンドを実行します。

oc get knativeserving.operator.knative.dev/knative-serving -n knative-serving --template='{{range .status.conditions}}{{printf "%s=%s\n" .type .status}}{{end}}'$ oc get knativeserving.operator.knative.dev/knative-serving -n knative-serving --template='{{range .status.conditions}}{{printf "%s=%s\n" .type .status}}{{end}}'Copy to Clipboard Copied! Toggle word wrap Toggle overflow 出力例

DependenciesInstalled=True DeploymentsAvailable=True InstallSucceeded=True Ready=True

DependenciesInstalled=True DeploymentsAvailable=True InstallSucceeded=True Ready=TrueCopy to Clipboard Copied! Toggle word wrap Toggle overflow 注記Knative Serving リソースが作成されるまでに数分の時間がかかる場合があります。

条件のステータスが

UnknownまたはFalseである場合は、しばらく待ってから、リソースが作成されたことを再度確認します。Knative Serving リソースが作成されていることを確認します。

oc get pods -n knative-serving

$ oc get pods -n knative-servingCopy to Clipboard Copied! Toggle word wrap Toggle overflow 出力例

Copy to Clipboard Copied! Toggle word wrap Toggle overflow 必要なネットワークコンポーネントが、自動的に作成された

knative-serving-ingressnamespace にインストールされていることを確認します。oc get pods -n knative-serving-ingress

$ oc get pods -n knative-serving-ingressCopy to Clipboard Copied! Toggle word wrap Toggle overflow 出力例

NAME READY STATUS RESTARTS AGE net-kourier-controller-7d4b6c5d95-62mkf 1/1 Running 0 76s net-kourier-controller-7d4b6c5d95-qmgm2 1/1 Running 0 76s 3scale-kourier-gateway-6688b49568-987qz 1/1 Running 0 75s 3scale-kourier-gateway-6688b49568-b5tnp 1/1 Running 0 75s

NAME READY STATUS RESTARTS AGE net-kourier-controller-7d4b6c5d95-62mkf 1/1 Running 0 76s net-kourier-controller-7d4b6c5d95-qmgm2 1/1 Running 0 76s 3scale-kourier-gateway-6688b49568-987qz 1/1 Running 0 75s 3scale-kourier-gateway-6688b49568-b5tnp 1/1 Running 0 75sCopy to Clipboard Copied! Toggle word wrap Toggle overflow

4.4. 次のステップ

- Knative イベント駆動型アーキテクチャーを使用する必要がある場合は、Knative Eventing をインストール できます。

第5章 Knative Eventing のインストール

クラスターでイベント駆動型アーキテクチャーを使用するには、Knative Eventing をインストールします。イベントソース、ブローカー、チャネルなどの Knative コンポーネントを作成し、それらを使用してアプリケーションや外部システムにイベントを送信することができます。

OpenShift Serverless Operator をインストールした後、デフォルト設定を使用して Knative Eventing をインストールすることも、KnativeEventing カスタムリソース (CR) でより詳細な設定を設定することもできます。KnativeEventing CR の設定オプションの詳細については、グローバル設定 を参照してください。

OpenShift Serverless で Red Hat 分散トレースを使用する 場合は、Knative Eventing をインストールする前に、Red Hat 分散トレースをインストールして設定する必要があります。

5.1. Web コンソールを使用した Knative Eventing のインストール

OpenShift Serverless Operator をインストールした後、OpenShift Container Platform の Web コンソールを使用して Knative Eventing をインストールします。デフォルトの設定で Knative Eventing をインストールするか、KnativeEventing カスタムリソース (CR) でより詳細な設定を行うことが可能です。

前提条件

- OpenShift Container Platform に対するクラスター管理者権限があるか、Red Hat OpenShift Service on AWS または OpenShift Dedicated に対するクラスターまたは専用管理者権限がある。

- OpenShift Container Platform Web コンソールにログインしている。

- OpenShift Serverless Operator がインストールされている。

手順

- OpenShift Container Platform Web コンソールの Administrator パースペクティブで、Operators → Installed Operators に移動します。

- ページ上部の Project ドロップダウンメニューが Project: knative-eventing に設定されていることを確認します。

- OpenShift Serverless Operator の Provided API 一覧で Knative Eventing をクリックし、Knative Eventing タブに移動します。

- Create Knative Eventing をクリックします。

Create Knative Eventing ページでは、提供されたフォームを使用するか、YAML ファイルを編集して、

KnativeEventingオブジェクトを設定できます。-

KnativeEventingオブジェクトの作成を完全に制御する必要がない、より単純な設定には、このフォームを使用します。

-

Create をクリックします。

-

KnativeEventingオブジェクトの作成を完全に制御する必要がある、より複雑な設定の場合は、YAML ファイルを編集します。YAML エディターにアクセスするには、Create Knative Eventing ページで YAML の編集 をクリックします。

-

-

Knative Eventing のインストール後に、

KnativeEventingオブジェクトが作成され、Knative Eventing タブに自動的にダイレクトされます。リソースの一覧にknative-eventingリソースが表示されます。

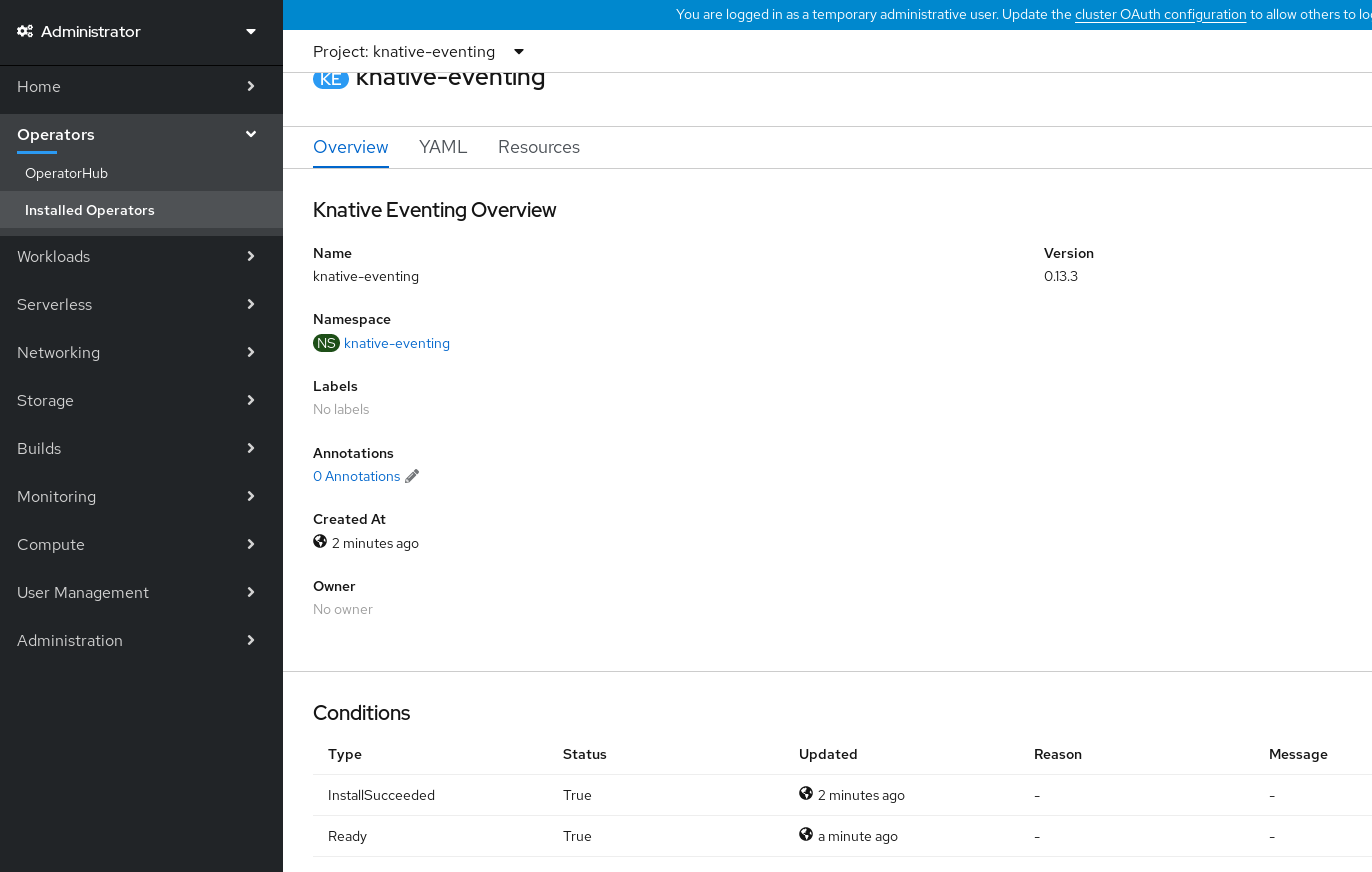

検証

-

Knative Eventing タブで

knative-eventingカスタムリソースをクリックします。 Knative Eventing Overview ページに自動的にダイレクトされます。

- スクロールダウンして、Conditions のリストを確認します。

ステータスが True の条件のリストが表示されます (例のイメージを参照)。

注記

注記Knative Eventing リソースが作成されるまでに数秒の時間がかかる場合があります。Resources タブでステータスを確認できます。

- 条件のステータスが Unknown または False である場合は、しばらく待ってから、リソースが作成されたことを再度確認します。

5.2. YAML を使用した Knative Eventing のインストール

OpenShift Serverless Operator をインストールした後、デフォルト設定を使用して Knative Eventing をインストールすることも、KnativeEventing カスタムリソース (CR) でより詳細な設定を設定することもできます。YAML ファイルと oc CLI を利用して、以下の手順で Knative Eventing をインストールすることができます。

前提条件

- OpenShift Container Platform に対するクラスター管理者権限があるか、Red Hat OpenShift Service on AWS または OpenShift Dedicated に対するクラスターまたは専用管理者権限がある。

- OpenShift Serverless Operator がインストールされている。

-

OpenShift CLI (

oc) がインストールされている。

手順

-

eventing.yamlという名前のファイルを作成します。 以下のサンプル YAML を

eventing.yamlにコピーします。apiVersion: operator.knative.dev/v1beta1 kind: KnativeEventing metadata: name: knative-eventing namespace: knative-eventingapiVersion: operator.knative.dev/v1beta1 kind: KnativeEventing metadata: name: knative-eventing namespace: knative-eventingCopy to Clipboard Copied! Toggle word wrap Toggle overflow - オプション: Knative Eventing デプロイメントについて実装する必要のある変更を YAML に加えます。

以下を入力して

eventing.yamlファイルを適用します。oc apply -f eventing.yaml

$ oc apply -f eventing.yamlCopy to Clipboard Copied! Toggle word wrap Toggle overflow

検証

以下のコマンドを入力して出力を確認し、インストールが完了したことを確認します。

oc get knativeeventing.operator.knative.dev/knative-eventing \ -n knative-eventing \ --template='{{range .status.conditions}}{{printf "%s=%s\n" .type .status}}{{end}}'$ oc get knativeeventing.operator.knative.dev/knative-eventing \ -n knative-eventing \ --template='{{range .status.conditions}}{{printf "%s=%s\n" .type .status}}{{end}}'Copy to Clipboard Copied! Toggle word wrap Toggle overflow 出力例

InstallSucceeded=True Ready=True

InstallSucceeded=True Ready=TrueCopy to Clipboard Copied! Toggle word wrap Toggle overflow 注記Knative Eventing リソースが作成されるまでに数秒の時間がかかる場合があります。

-

条件のステータスが

UnknownまたはFalseである場合は、しばらく待ってから、リソースが作成されたことを再度確認します。 以下のコマンドを実行して Knative Eventing リソースが作成されていることを確認します。

oc get pods -n knative-eventing

$ oc get pods -n knative-eventingCopy to Clipboard Copied! Toggle word wrap Toggle overflow 出力例

Copy to Clipboard Copied! Toggle word wrap Toggle overflow

5.3. Apache Kafka の Knative ブローカーのインストール

Apache Kafka の Knative ブローカー実装では、サポートされているバージョンの Apache Kafka メッセージストリーミングプラットフォームを OpenShift Serverless で使用できるように、統合オプションが提供されています。KnativeKafka カスタムリソースをインストールしている場合、Apache Kafka 機能の Knative ブローカーは OpenShift Serverless インストールで使用できます。

前提条件

- OpenShift Serverless Operator および Knative Eventing がクラスターにインストールされている。

- Red Hat AMQ Streams クラスターにアクセスできる。

-

検証手順を使用する場合は、OpenShift CLI (

oc) をインストールしている。 - OpenShift Container Platform に対するクラスター管理者権限があるか、Red Hat OpenShift Service on AWS または OpenShift Dedicated に対するクラスターまたは専用管理者権限がある。

- OpenShift Container Platform Web コンソールにログインしている。

手順

- Administrator パースペクティブで、Operators → Installed Operators に移動します。

- ページ上部の Project ドロップダウンメニューが Project: knative-eventing に設定されていることを確認します。

- OpenShift Serverless Operator の Provided APIs のリストで Knative Kafka ボックスを見つけ、Create Instance をクリックします。

Create Knative Kafka ページで KnativeKafka オブジェクトを設定します。

重要クラスターで Kafka チャネル、ソース、ブローカー、またはシンクを使用するには、使用するオプションの 有効な スイッチを true に切り替える必要があります。これらのスイッチは、デフォルトで false に設定されます。さらに、Kafka チャネル、ブローカー、またはシンクを使用するには、ブートストラップサーバーを指定する必要があります。

- KnativeKafka オブジェクトの作成を完全に制御する必要がない、より単純な設定には、このフォームを使用します。

KnativeKafka オブジェクトの作成を完全に制御する必要がある、より複雑な設定の場合は YAML を編集します。YAML にアクセスするには、Create Knative Kafka ページの Edit YAML リンクをクリックします。

KnativeKafkaカスタムリソースの例Copy to Clipboard Copied! Toggle word wrap Toggle overflow - 1

- 開発者はクラスターで

KafkaChannelチャネルを使用できます。 - 2

- AMQ Streams クラスターからのブートストラップサーバーのコンマ区切りのリスト。

- 3

- 開発者はクラスターで

KafkaSourceイベントソースタイプを使用できます。 - 4

- 開発者はクラスターで Apache Kafka 用の Knative ブローカー実装を使用できます。

- 5

- Red Hat AMQ Streams クラスターからのブートストラップサーバーのコンマ区切りリスト。

- 6

Brokerオブジェクトでサポートされる Kafka トピックのパーティション数を定義します。デフォルトは10です。- 7

Brokerオブジェクトでサポートされる Kafka トピックのレプリケーション係数を定義します。デフォルトは3です。replicationFactorの値は、Red Hat AMQ Streams クラスターのノード数以下である必要があります。- 8

- 開発者がクラスター内で Kafka シンクを使用できるようにします。

- 9

- Kafka データプレーンのログレベルを定義します。許可される値は、

TRACE、DEBUG、INFO、WARN、およびERRORです。デフォルト値はINFOです。

警告実稼働環境では、ログレベルとして

DEBUGまたはTRACEを使用しないでください。これらのログレベルからの出力は冗長であり、パフォーマンスが低下する可能性があります。

- Kafka のオプションの設定が完了したら、Create をクリックします。Knative Kafka タブに自動的にダイレクトされます。ここで、knative-kafka はリソースのリストにあります。

検証

- Knative Kafka タブで knative-kafka リソースをクリックします。Knative Kafka Overview ページに自動的にダイレクトされます。

リソースの Conditions (状態) のリストを表示し、それらのステータスが True であることを確認します。

状態のステータスが Unknown または False である場合は、ページを更新するためにしばらく待機します。

Apache Kafka リソースの Knative ブローカーが作成されたことを確認します。

oc get pods -n knative-eventing

$ oc get pods -n knative-eventingCopy to Clipboard Copied! Toggle word wrap Toggle overflow 出力例

Copy to Clipboard Copied! Toggle word wrap Toggle overflow

5.4. 次のステップ

- Knative サービスを使用する場合は、Knative Serving をインストールできます。

第6章 Apache Kafka の Knative ブローカーの設定

Apache Kafka の Knative ブローカー実装では、サポートされているバージョンの Apache Kafka メッセージストリーミングプラットフォームを OpenShift Serverless で使用できるように、統合オプションが提供されています。Kafka は、イベントソース、チャネル、ブローカー、およびイベントシンク機能のオプションを提供します。

コア OpenShift Serverless インストールの一部として提供される Knative Eventing コンポーネントに加えて、KnativeKafka カスタムリソース (CR) は次の方法でインストールできます。

- OpenShift Container Platform のクラスター管理者

- Red Hat OpenShift Service on AWS または OpenShift Dedicated のクラスターまたは Dedicated 管理者

KnativeKafka CR は、ユーザーに以下のような追加オプションを提供します。

- Kafka ソース

- Kafka チャネル

- Kafka ブローカー

- Kafka シンク

第7章 Apache Kafka の Knative 用に kube-rbac-proxy を設定する

kube-rbac-proxy コンポーネントは、Apache Kafka の内部認証および認可機能を提供します。

7.1. Apache Kafka の Knative 用に kube-rbac-proxy リソースを設定する

OpenShift Serverless Operator CR を使用して、kube-rbac-proxy コンテナーのリソース割り当てをグローバルにオーバーライドできます。

特定のデプロイメントのリソース割り当てをオーバーライドすることもできます。

次の設定では、Knative Kafka kube-rbac-proxy の最小および最大の CPU およびメモリー割り当てを設定します。

KnativeKafka CR の例

第8章 OpenShift Serverless Functions の設定

アプリケーションコードのデプロイプロセスを改善するために、OpenShift Serverless を使用して、ステートレスでイベント駆動型の関数を Knative サービスとして OpenShift Container Platform にデプロイできます。関数を開発する場合は、セットアップ手順を完了する必要があります。

8.1. 前提条件

クラスターで OpenShift Serverless Functions の使用を有効にするには、以下の手順を実行する必要があります。

OpenShift Serverless Operator および Knative Serving がクラスターにインストールされている。

注記関数は Knative サービスとしてデプロイされます。関数でイベント駆動型のアーキテクチャーを使用する必要がある場合は、Knative Eventing もインストールする必要があります。

-

ocCLI がインストールされている。 -

Knative (

kn) CLI がインストールされている。Knative CLI をインストールすると、関数の作成および管理に使用できるkn funcコマンドを使用できます。 - Docker Container Engine または Podman バージョン 3.4.7 以降がインストールされている。

- OpenShift Container Registry などの利用可能なイメージレジストリーにアクセスできる。

- Quay.io をイメージレジストリーとして使用する場合は、リポジトリーがプライベートではないか確認するか、OpenShift Container Platform ドキュメント Pod が他のセキュアなレジストリーからイメージを参照できるようにする設定 に従っていることを確認している。

- OpenShift Container レジストリーを使用している場合は、クラスター管理者が レジストリーを公開する 必要があります。

8.2. Podman の設定

高度なコンテナー管理機能を使用するには、OpenShift Serverless Functions で Podman を使用することが推奨されます。そのためには、Podman サービスを開始し、それに接続するように Knative (kn) CLI を設定する必要があります。

手順

${XDG_RUNTIME_DIR}/podman/podman.sockで、UNIX ソケットで Docker API を提供する Podman サービスを起動します。systemctl start --user podman.socket

$ systemctl start --user podman.socketCopy to Clipboard Copied! Toggle word wrap Toggle overflow 注記多くのシステムでは、このソケットは

/run/user/$(id -u)/podman/podman.sockにあります。関数のビルドに使用する環境変数を確立します。

export DOCKER_HOST="unix://${XDG_RUNTIME_DIR}/podman/podman.sock"$ export DOCKER_HOST="unix://${XDG_RUNTIME_DIR}/podman/podman.sock"Copy to Clipboard Copied! Toggle word wrap Toggle overflow -vフラグを指定して、関数プロジェクトディレクトリー内で build コマンドを実行し、詳細な出力を表示します。ローカルの UNIX ソケットへの接続が表示されるはずです。kn func build -v

$ kn func build -vCopy to Clipboard Copied! Toggle word wrap Toggle overflow

8.3. macOS での Podman のセットアップ

高度なコンテナー管理機能を使用するには、OpenShift Serverless Functions で Podman を使用することが推奨されます。macOS でこれを行うには、Podman マシンを起動し、それに接続するように Knative (kn) CLI を設定する必要があります。

手順

Podman マシンを作成します。

podman machine init --memory=8192 --cpus=2 --disk-size=20

$ podman machine init --memory=8192 --cpus=2 --disk-size=20Copy to Clipboard Copied! Toggle word wrap Toggle overflow UNIX ソケットで Docker API を提供する Podman マシンを開始します。

Copy to Clipboard Copied! Toggle word wrap Toggle overflow 注記ほとんどの macOS システムでは、このソケットは

/Users/myuser/.local/share/containers/podman/machine/podman-machine-default/podman.sockにあります。関数のビルドに使用する環境変数を確立します。

export DOCKER_HOST='unix:///Users/myuser/.local/share/containers/podman/machine/podman-machine-default/podman.sock'

$ export DOCKER_HOST='unix:///Users/myuser/.local/share/containers/podman/machine/podman-machine-default/podman.sock'Copy to Clipboard Copied! Toggle word wrap Toggle overflow -vフラグを指定して、関数プロジェクトディレクトリー内で build コマンドを実行し、詳細な出力を表示します。ローカルの UNIX ソケットへの接続が表示されるはずです。kn func build -v

$ kn func build -vCopy to Clipboard Copied! Toggle word wrap Toggle overflow

8.4. 次のステップ

- Docker Container Engine または Podman の詳細は、コンテナービルドツールのオプション を参照してください。

- 関数を使い始めるを参照してください。

第9章 Serverless のアップグレード

OpenShift Serverless は、リリースバージョンをスキップせずにアップグレードする必要があります。本セクションでは、アップグレードに関する問題を解決する方法を説明します。

9.1. Serverless Operator メンテナンスリリースのアップグレード

9.1.1. 最新リリースとメンテナンスリリース

OpenShift Serverless 1.29 以降、次のようなさまざまな製品バージョンが利用できます。

-

最新リリースは

stableチャネルから入手できます。 メンテナンスリリースは、バージョンベースのチャネル (

stable-1.29など) を通じて入手できます。注記メンテナンスリリースは、最新リリースよりも前のリリースです。たとえば、

stableチャネルにバージョン 1.30 が含まれている場合、メンテナンスリリースはstable-1.29チャネルで利用可能になります。

バージョンベースのチャネルを使用すると、特定の xy ストリーム内にとどまることができます。さらに、重大な変更が含まれる可能性がある製品の最新バージョンへのアップグレードが妨げられます。

メンテナンスリリースに切り替えるには、サブスクリプションオブジェクト YAML ファイルのチャネルパラメーターを stable から対応するバージョンベースのチャネル (stable-1.29 など) に更新します。

9.1.2. メンテナンスリリースのパッチとホットフィックス

安定版リリースと同様に、メンテナンスリリースにはパッチとホットフィックスが適用されるため、重要なバグやセキュリティーの修正によりデプロイメントを最新の状態に保つことができます。

- パッチは、z-release として配布される更新です。たとえば、OpenShift Serverless 1.29.1 は、バージョン 1.29.0 以降に行われた更新を提供するパッチです。

ホットフィックスは、ダウンタイムを必要とせず、運用環境で直接使用される修正です。これらは、最新のリリースされたバージョンではなく、顧客がデプロイメントしたバージョンをアップグレードするという点で、通常の更新とは異なります。

ホットフィックスは、すべてのお客様にすぐに提供されるわけではありません。ただし、ホットフィックスによって導入された変更は、多くの場合、将来のリリースの一部としてすべての顧客が利用できるようになります。

導入に関連するホットフィックスが利用可能になると、サブスクリプションを更新してホットフィックスを入手するためのホットフィックス CatalogSource が提供されます。

新しいオペレーターのリリースが利用可能になった後、ホットフィックスを適用してデプロイされたオペレーターもアップグレードできます。最新の GA バージョンを使用するには、ホットフィックスの代わりにパブリック CatalogSource を使用するようにサブスクリプションを変更します。

次の図は、パッチとホットフィックスがどのように機能するかを示しています。

9.1.3. メンテナンスリリースのアップグレードパス

バージョンベースのチャネルを使用している場合は、チャネルまたはヘッドでいつでも最新バージョンにアップグレードできます。たとえば、stable-1.29 チャネルでは 1.29.0 から 1.29.2 にアップグレードできます。

さらに、チャネルの先頭から、次の xy リリースにアップグレードできます。たとえば、1.29.2 が stable-1.29 チャネルの先頭である場合、1.29.2 から 1.30 にアップグレードできます。このようなクロスチャネル更新は自動的には行われないため、管理者はサブスクリプションを更新してチャネルを手動で切り替える必要があります。

9.1.4. アップグレードの例

9.1.4.1. シナリオ 1

このシナリオでは、次の状況が当てはまります。

-

チャネルが

stable-1.28 -

stableチャネルに切り替えている - 現在インストールされているバージョンは 1.28.0

- 1.29.0 は 1.28.1 より前にリリースされている

-

1.30.0 は

stableチャネルのヘッド

このシナリオにおける stable-1.28 の 1.28.0 から stable の 1.29.0 へのアップグレードパスは、1.28.0、1.28.1、1.29.0 です。

9.1.4.2. シナリオ 2

このシナリオでは、次の状況が当てはまります。

-

チャネルは

stable-1.29 - 現在インストールされているバージョンは 1.29.0

-

1.29.1 は、

1. 30.0がstableチャネルにリリースされる前にstable-1.29チャネルとstableチャネルの両方にリリースされている

このシナリオでは、stable-1.29 の 1.29.0 から stable の 1.30.0 へのアップグレードパスは、1.29.0 から 1.29.1 から 1.30.0 です。

9.1.4.3. シナリオ 3

このシナリオでは、次の状況が当てはまります。

-

チャネルは

stable-1.29 -

stable-1.30チャネルに切り替えている - 現在インストールされているバージョンは 1.29.1

-

1.29.1 は

stable-1.29チャネルのヘッド

このシナリオでは、stable-1.29 の 1.29.1 から stable-1.30 の 1.30.0 へのアップグレードパスは、1.29.1 から 1.30.0 です。

9.2. OpenShift Serverless Operator のアップグレードの失敗の解決

たとえば、手動のアンインストールや再インストールの実行時に、OpenShift Serverless Operator のアップグレード時にエラーが発生する可能性があります。エラーが発生した場合は、OpenShift Serverless Operator を手動で再インストールする必要があります。

手順

最初に OpenShift Serverless リリースノートを検索してインストールされた OpenShift Serverless Operator のバージョンを特定します。

たとえば、アップグレードの試行時のエラーメッセージには以下の文字列が含まれる場合があります。

The installed KnativeServing version is v1.5.0.

The installed KnativeServing version is v1.5.0.Copy to Clipboard Copied! Toggle word wrap Toggle overflow この例では、KnativeServing

MAJOR.MINORバージョンは1.5です。これは、OpenShift Serverless 1.26 のリリースノートで説明しています。OpenShift Serverless は Knative Serving 1.5 を使用するようになりました。- OpenShift Serverless Operator とそのすべてのインストール計画をアンインストールします。

最初の手順で検出された OpenShift Serverless Operator のバージョンを手動でインストールします。インストールするには、以下の例のように

serverless-subscription.yamlファイルを作成します。Copy to Clipboard Copied! Toggle word wrap Toggle overflow 次に、以下のコマンドを実行してサブスクリプションをインストールします。

oc apply -f serverless-subscription.yaml

$ oc apply -f serverless-subscription.yamlCopy to Clipboard Copied! Toggle word wrap Toggle overflow - アップグレードインストールプランが表示される際に手動で承認してアップグレードします。