OpenShift での AMQ Streams の設定

OpenShift ContainerPlatform での AMQ Streams 2.3 のデプロイメントの設定および管理

概要

多様性を受け入れるオープンソースの強化

Red Hat では、コード、ドキュメント、Web プロパティーにおける配慮に欠ける用語の置き換えに取り組んでいます。まずは、マスター (master)、スレーブ (slave)、ブラックリスト (blacklist)、ホワイトリスト (whitelist) の 4 つの用語の置き換えから始めます。この取り組みは膨大な作業を要するため、今後の複数のリリースで段階的に用語の置き換えを実施して参ります。詳細は、Red Hat CTO である Chris Wright のメッセージ をご覧ください。

第1章 設定の概要

AMQ Streams は、OpenShift クラスターで Apache Kafka を実行するプロセスを簡素化します。

このガイドでは、AMQ Streams デプロイメントを設定および管理する方法について説明します。

1.1. カスタムリソースの設定

カスタムリソースを使用して、AMQ Streams デプロイメントを設定します。

カスタムリソースを使用して、次のコンポーネントのインスタンスを設定および作成できます。

- Kafka クラスター

- Kafka Connect クラスター

- Kafka MirrorMaker

- Kafka Bridge

- Cruise Control

カスタムリソース設定を使用してインスタンスを管理したり、デプロイメントを変更して追加機能を導入したりすることもできます。これには、以下をサポートする設定が含まれる場合があります。

- Kafka ブローカーへのクライアントアクセスの保護

- クラスター外からの Kafka ブローカーへのアクセス

- トピックの作成

- ユーザー (クライアント) の作成

- フィーチャーゲートの制御

- ロギングの頻度変更

- リソース制限とリクエストの割り当て

- AMQ Streams Drain Cleaner、Cruise Control、分散トレースなどの機能紹介

カスタムリソース API リファレンス では、設定で使用できるプロパティーを説明しています。

1.2. ConfigMap を使用した設定の追加

ConfigMap リソースを使用して、特定の設定を AMQ Streams デプロイメントに追加します。ConfigMap はキーと値のペアを使用して機密ではないデータを保存します。ConfigMap に追加された設定データは 1 か所に保持され、コンポーネント間で再利用できます。

ConfigMap は、以下に関連する設定データのみを保存できます。

- ロギングの設定

- メトリクスの設定

- Kafka Connect コネクターの外部設定

設定の他の領域に ConfigMap を使用することはできません。

コンポーネントを設定する場合、configMapKeyRef プロパティーを使用して ConfigMap への参照を追加できます。

たとえば、configMapKeyRef を使用してロギングの設定を提供する ConfigMap を参照できます。ConfigMap を使用して Log4j 設定ファイルを渡すことができます。参照を logging 設定に追加します。

ロギングの ConfigMap の例

spec:

# ...

logging:

type: external

valueFrom:

configMapKeyRef:

name: my-config-map

key: my-config-map-key

メトリクス設定に ConfigMap を使用するには、同じ方法でコンポーネントの metricsConfig 設定への参照を追加します。

ExternalConfiguration プロパティーは、Pod にマウントされた ConfigMap (またはシークレット) からのデータを環境変数またはボリュームとして使用できるようにします。Kafka Connect によって使用されるコネクターの外部設定データを使用できます。データは外部データソースに関連する可能性があり、コネクターがそのデータソースと通信するために必要な値を指定します。

たとえば、configMapKeyRef プロパティーを使用して、ConfigMap から設定データを環境変数として渡すことができます。

環境変数の値を提供する ConfigMap の例

apiVersion: kafka.strimzi.io/v1beta2

kind: KafkaConnect

metadata:

name: my-connect

spec:

# ...

externalConfiguration:

env:

- name: MY_ENVIRONMENT_VARIABLE

valueFrom:

configMapKeyRef:

name: my-config-map

key: my-key外部で管理される ConfigMap を使用している場合は、設定プロバイダーを使用して ConfigMap にデータを読み込みます。設定プロバイダーの使用の詳細は、3章外部ソースからの設定値の読み込み を参照してください。

1.2.1. カスタム ConfigMap の命名

AMQ Streams は、OpenShift にデプロイされると、独自の ConfigMap およびその他のリソースを作成 します。ConfigMap には、コンポーネントの実行に必要なデータが含まれます。AMQ Streams によって作成された ConfigMap は編集しないでください。

作成するカスタム ConfigMap にはこれらのデフォルト ConfigMap と同じ名前がないことを確認します。名前が同じ場合は上書きされます。たとえば、ConfigMap が Kafka クラスターの ConfigMap と同じ名前である場合、Kafka クラスターの更新がある場合に上書きされます。

1.3. Kafka ブローカーに接続するためのリスナー設定

リスナーは、Kafka ブローカーへのクライアント接続に使用されます。AMQ Streams は、Kafka リソースを介してリスナーを設定するためのプロパティーを備えたジェネリックな GenericKafkaListener スキーマを提供しています。

GenericKafkaListener は、リスナー設定に柔軟なアプローチを提供します。プロパティーを指定して、OpenShift クラスター内で接続する 内部 リスナーを設定したり、OpenShift クラスター外部で接続する 外部 リスナーを設定したりできます。

各リスナーは Kafka リソースの配列として定義されます。名前とポートが一意であれば、必要なリスナーをいくつでも設定できます。リスナーを設定して、認証を使用したセキュアな接続を確立できます。

1.3.1. 内部リスナーの設定

内部リスナーは、クライアントを OpenShift クラスター内の Kafka ブローカーに接続します。internal タイプのリスナー設定は、ヘッドレスサービスと、ブローカー Pod に指定された DNS 名を使用します。

OpenShift ネットワークを外部ネットワークに参加させる必要がある場合があります。その場合、OpenShift サービスの DNS ドメイン (通常は .cluster.local) が使用されないように、内部 タイプのリスナーを (useServiceDnsDomain プロパティーを使用して) 設定できます。

ブローカーごとの ClusterIP サービスに基づいて Kafka クラスターを公開する cluster-ip タイプのリスナーを設定することもできます。これは、ヘッドレスサービスを介してルーティングできない場合や、カスタムアクセスメカニズムを組み込みたい場合に便利なオプションです。たとえば、特定の Ingress コントローラーまたは OpenShift Gateway API 用に独自のタイプの外部リスナーを構築するときに、このリスナーを使用できます。

1.3.2. 外部リスナーの設定

異なる認証メカニズムを必要とするネットワークから Kafka クラスターへのアクセスを処理するように、外部リスナーを設定します。

ロードバランサーやルートなどの指定された接続メカニズムを使用して、OpenShift 環境外部のクライアントアクセスに対して外部リスナーを設定できます。

1.3.3. リスナー証明書の提供

TLS 暗号化が有効になっている TLS リスナーまたは外部リスナーの、Kafka リスナー証明書 と呼ばれる独自のサーバー証明書を提供できます。詳細は Kafka リスナー証明書 を参照してください。

外部リスナーの使用時に Kafka クラスターをスケーリングする場合、すべての Kafka ブローカーのローリング更新がトリガーされる可能性があります。これは設定によって異なります。

1.4. 本書の表記慣例

ユーザーが置き換えた値

ユーザーが置き換える値は、置き換え可能 な値とも呼ばれ、山かっこ (<>) を付けて 斜体 で表示されます。アンダースコア ( _ ) は、複数単語の値に使用されます。値がコードまたはコマンドを参照する場合は monospace も使用されます。

たとえば、以下のコードでは <my_namespace> を namespace の名前に置き換えます。

sed -i 's/namespace: .*/namespace: <my_namespace>/' install/cluster-operator/*RoleBinding*.yaml第2章 OpenShift デプロイメントでの AMQ Streams の設定

カスタムリソースを使用して AMQ Streams の展開を設定します。AMQ Streams は、デプロイメント用の独自の Kafka コンポーネント設定を構築する際の開始点として役立つ 設定ファイルの例 を提供します。

カスタムリソースに適用されるラベルは、クラスターを設定する OpenShift リソースにも適用されます。そのため、必要に応じてリソースに簡単にラベルを付けることができます。

AMQ Streams デプロイメントのモニタリング

Prometheus および Grafana を使用して、AMQ Streams デプロイメントを監視できます。詳細は、Kafka に追加されたメトリクスの紹介 を参照してください。

2.1. 標準の Kafka 設定プロパティーの使用

標準の Kafka 設定プロパティーを使用して Kafka コンポーネントを設定します。

プロパティーは、以下の Kafka コンポーネントの設定を制御および調整するオプションを提供します。

- ブローカー

- トピック

- クライアント (プロデューサーとコンシューマー)

- 管理クライアント

- Kafka Connect

- Kafka Streams

ブローカーおよびクライアントパラメーターには、承認、認証、および暗号化を設定するオプションが含まれます。

AMQ Streams on OpenShift では、一部の設定プロパティーは AMQ Streams によって完全に管理されており、変更できません。

Kafka 設定プロパティーの詳細と、プロパティーを使用してデプロイメントを調整する方法は、以下のガイドを参照してください。

2.2. Kafka クラスターの設定

Kafka リソースを使用して Kafka デプロイメントを設定します。Kafka クラスターは ZooKeeper クラスターと共にデプロイされるため、Kafka リソース内の ZooKeeper の設定オプションも使用できます。Entity Operator は Topic Operator と User Operator で設定されます。Kafka リソースの entityOperator プロパティーを設定して、Topic Operator と User Operator をデプロイメントに含めることもできます。

「Kafka スキーマ参照」 Kafka リソースの完全なスキーマについて説明します。

Apache Kafka の詳細については、Apache Kafka のドキュメント を参照してください。

リスナーの設定

クライアントを Kafka ブローカーに接続するためのリスナーを設定します。ブローカーに接続するためのリスナーの設定に関する詳細は、リスナーの設定 を参照してください。

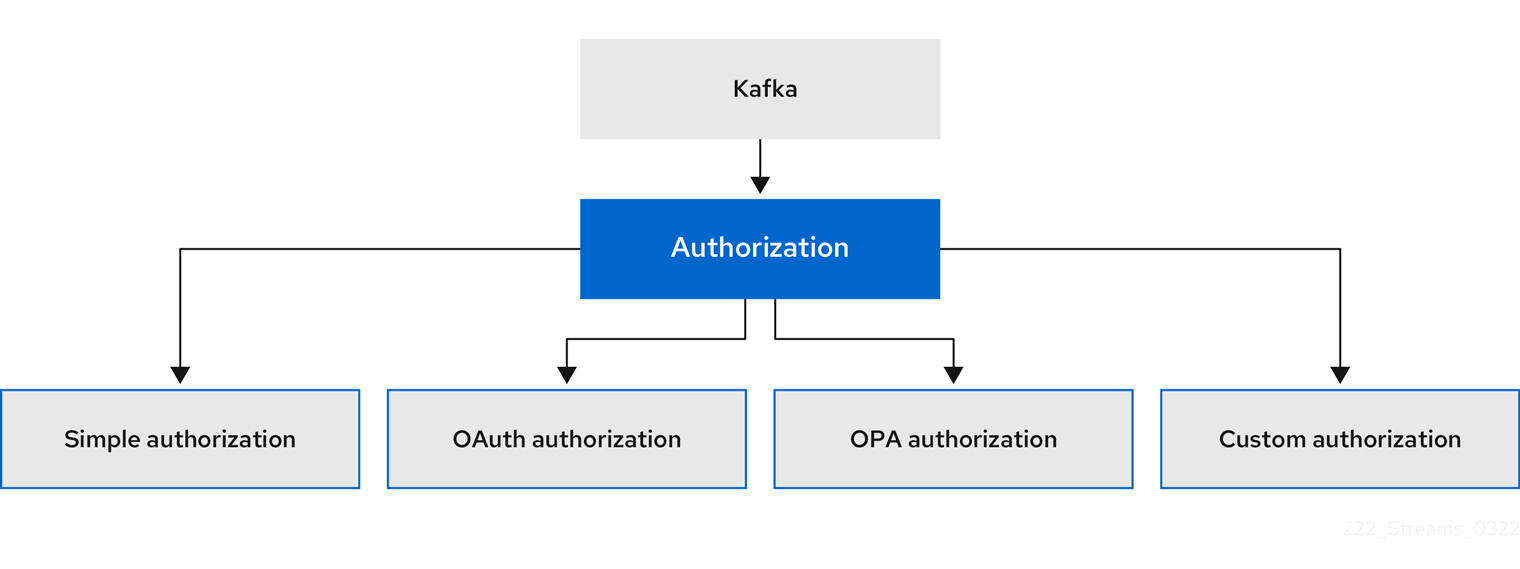

Kafka へのアクセスの承認

ユーザーが実行するアクションを許可または拒否するように Kafka クラスターを設定できます。詳細は、Kafka ブローカーへのアクセスの保護 を参照してください。

TLS 証明書の管理

Kafka をデプロイする場合、Cluster Operator は自動で TLS 証明書の設定および更新を行い、クラスター内での暗号化および認証を有効にします。必要な場合は、更新期間の開始前にクラスターおよびクライアント CA 証明書を手動で更新できます。クラスターおよびクライアント CA 証明書によって使用される鍵を置き換えることもできます。詳細は、CA 証明書の手動更新 および 秘密鍵の置換 を参照してください。

2.2.1. Kafka の設定

Kafka リソースのプロパティーを使用して、Kafka デプロイメントを設定します。

Kafka の設定に加え、ZooKeeper および AMQ Streams Operator の設定を追加することもできます。ロギングやヘルスチェックなどの一般的な設定プロパティーは、コンポーネントごとに独立して設定されます。

この手順では、可能な設定オプションの一部のみを取り上げますが、特に重要なオプションは次のとおりです。

- リソース要求 (CPU/メモリー)

- 最大および最小メモリー割り当ての JVM オプション

- リスナー (およびクライアントの認証)

- 認証

- ストレージ

- ラックアウェアネス

- メトリクス

- Cruise Control によるクラスターのリバランス

Kafka バージョン

Kafka config の inter.broker.protocol.version プロパティーは、指定された Kafka バージョン (spec.kafka.version) によってサポートされるバージョンである必要があります。このプロパティーは、Kafka クラスターで使用される Kafka プロトコルのバージョンを表します。

Kafka 3.0.0 以降、inter.broker.protocol.version が 3.0 以上に設定されていると、log.message.format.version オプションは無視されるため、設定する必要はありません。

Kafka バージョンのアップグレード時には、inter.broker.protocol.version のアップグレードが必要です。詳細は、Upgrading Kafka を参照してください。

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator

以下をデプロイする手順については、 OpenShift での AMQ Streams のデプロイおよびアップグレード を参照してください。

手順

Kafkaリソースのspecプロパティーを編集します。設定可能なプロパティーは以下の例のとおりです。

apiVersion: kafka.strimzi.io/v1beta2 kind: Kafka metadata: name: my-cluster spec: kafka: replicas: 31 version: 3.3.12 logging:3 type: inline loggers: kafka.root.logger.level: "INFO" resources:4 requests: memory: 64Gi cpu: "8" limits: memory: 64Gi cpu: "12" readinessProbe:5 initialDelaySeconds: 15 timeoutSeconds: 5 livenessProbe: initialDelaySeconds: 15 timeoutSeconds: 5 jvmOptions:6 -Xms: 8192m -Xmx: 8192m image: my-org/my-image:latest7 listeners:8 - name: plain9 port: 909210 type: internal11 tls: false12 configuration: useServiceDnsDomain: true13 - name: tls port: 9093 type: internal tls: true authentication:14 type: tls - name: external15 port: 9094 type: route tls: true configuration: brokerCertChainAndKey:16 secretName: my-secret certificate: my-certificate.crt key: my-key.key authorization:17 type: simple config:18 auto.create.topics.enable: "false" offsets.topic.replication.factor: 3 transaction.state.log.replication.factor: 3 transaction.state.log.min.isr: 2 default.replication.factor: 3 min.insync.replicas: 2 inter.broker.protocol.version: "3.3" ssl.cipher.suites: "TLS_ECDHE_RSA_WITH_AES_256_GCM_SHA384"19 ssl.enabled.protocols: "TLSv1.2" ssl.protocol: "TLSv1.2" storage:20 type: persistent-claim21 size: 10000Gi22 rack:23 topologyKey: topology.kubernetes.io/zone metricsConfig:24 type: jmxPrometheusExporter valueFrom: configMapKeyRef:25 name: my-config-map key: my-key # ... zookeeper:26 replicas: 327 logging:28 type: inline loggers: zookeeper.root.logger: "INFO" resources: requests: memory: 8Gi cpu: "2" limits: memory: 8Gi cpu: "2" jvmOptions: -Xms: 4096m -Xmx: 4096m storage: type: persistent-claim size: 1000Gi metricsConfig: # ... entityOperator:29 tlsSidecar:30 resources: requests: cpu: 200m memory: 64Mi limits: cpu: 500m memory: 128Mi topicOperator: watchedNamespace: my-topic-namespace reconciliationIntervalSeconds: 60 logging:31 type: inline loggers: rootLogger.level: "INFO" resources: requests: memory: 512Mi cpu: "1" limits: memory: 512Mi cpu: "1" userOperator: watchedNamespace: my-topic-namespace reconciliationIntervalSeconds: 60 logging:32 type: inline loggers: rootLogger.level: INFO resources: requests: memory: 512Mi cpu: "1" limits: memory: 512Mi cpu: "1" kafkaExporter:33 # ... cruiseControl:34 # ...- 1

- レプリカノードの数。クラスターにトピックがすでに定義されている場合は、クラスターをスケーリング できます。

- 2

- Kafka バージョン。アップグレード手順 に従うと、サポート対象のバージョンに変更できます。

- 3

- ConfigMap を介して直接 (

inline) または間接 (external) に追加された Kafka ロガーとログレベル。カスタム ConfigMap は、log4j.propertiesキー下に配置する必要があります。Kafkakafka.root.logger.levelロガーでは、ログレベルを INFO、ERROR、WARN、TRACE、DEBUG、FATAL または OFF に設定できます。 - 4

- 5

- コンテナーを再起動するタイミング (liveness) およびコンテナーがトラフィックを許可できるタイミング (readiness) を把握するための ヘルスチェック。

- 6

- Kafka を実行している仮想マシン (VM) のパフォーマンスを最適化するための JVM 設定オプション。

- 7

- 高度な任意設定: 特別な場合のみ推奨される コンテナーイメージの設定。

- 8

- リスナーは、ブートストラップアドレスでクライアントが Kafka クラスターに接続する方法を設定します。リスナーは、OpenShift クラスター内部または外部からの接続の 内部 または 外部 リスナーとして設定 されます。

- 9

- リスナーを識別するための名前。Kafka クラスター内で一意である必要があります。

- 10

- Kafka 内でリスナーによって使用されるポート番号。ポート番号は指定の Kafka クラスター内で一意である必要があります。許可されるポート番号は 9092 以上ですが、すでに Prometheus および JMX によって使用されているポート 9404 および 9999 以外になります。リスナーのタイプによっては、ポート番号は Kafka クライアントに接続するポート番号と同じではない場合があります。

- 11

internalまたはcluster-ip(ブローカーごとのClusterIPサービスを使用して Kafka を公開するため) として指定されたリスナータイプ、またはroute、loadbalancer、nodeportまたはingressとして指定された外部リスナーのタイプ。- 12

- 各リスナーの TLS 暗号化を有効にします。デフォルトは

falseです。routeリスナーに TLS 暗号化は必要ありません。 - 13

- クラスターサービス接尾辞 (通常は

cluster.local) を含む完全修飾 DNS 名が割り当てられているかどうかを定義します。 - 14

- mTLS、SCRAM-SHA-512、またはトークンベースの OAuth 2.0 として指定された リスナー認証メカニズム。

- 15

- 16

- 外部 CA (認証局) によって管理される Kafka リスナー証明書 のオプションの設定。

brokerCertChainAndKeyは、サーバー証明書および秘密鍵が含まれるSecretを指定します。TLS による暗号化が有効な任意のリスナーで Kafka リスナー証明書を設定できます。 - 17

- 承認は Kafka ブローカーで簡易、OAUTH2.0、または OPA 承認を有効化 します。簡易承認では、

AclAuthorizerKafka プラグインが使用されます。 - 18

- 19

- 20

- 21

- 永続ボリュームのストレージサイズは拡張可能 で、さらに JBOD ストレージへのボリューム追加が可能 です。

- 22

- 23

- 異なるラック、データセンター、または可用性ゾーンにレプリカを分散させるための Rack awareness 設定。

topologyKeyは、ラック ID を含むノードラベルと一致する必要があります。この設定で使用される例では、標準のtopology.kubernetes.io/zoneラベルを使用するゾーンを指定します。 - 24

- Prometheus メトリクス は有効になっています。この例では、メトリクスは Prometheus JMX Exporter (デフォルトのメトリクスエクスポーター) に対して設定されます。

- 25

- Prometheus JMX Exporter 経由でメトリクスを Grafana ダッシュボードにエクスポートする Prometheus ルール。Prometheus JMX Exporter の設定が含まれる ConfigMap を参照することで有効になります。

metricsConfig.valueFrom.configMapKeyRef.key配下に空のファイルが含まれる ConfigMap の参照を使用して、追加設定なしでメトリクスを有効にできます。 - 26

- Kafka 設定と似たプロパティーが含まれる、ZooKeeper 固有の設定。

- 27

- ZooKeeper ノードの数。通常、ZooKeeper クラスターまたはアンサンブルは、一般的に 3、5、7 個の奇数個のノードで実行されます。効果的なクォーラムを維持するには、過半数のノードが利用可能である必要があります。ZooKeeper クラスターでクォーラムを失うと、クライアントへの応答が停止し、Kafka ブローカーが機能しなくなります。AMQ Streams では、ZooKeeper クラスターの安定性および高可用性が重要になります。

- 28

- 指定された ZooKeeper ロガーおよびログレベル。

- 29

- Topic Operator および User Operator の設定を指定 する Entity Operator 設定。

- 30

- Entity Operator の TLS サイドカー設定。Entity Operator は、ZooKeeper とのセキュアな通信に TLS サイドカーを使用します。

- 31

- 指定された Topic Operator ロガーおよびログレベル。この例では、

inlineロギングを使用します。 - 32

- 指定された User Operator ロガーおよびログレベル。

- 33

- Kafka Exporter の設定。Kafka Exporter は、特にコンシューマーラグデータなどのメトリクスデータを Kafka ブローカーから抽出する任意のコンポーネントです。Kafka Exporter が適切に機能できるようにするには、コンシューマーグループを使用する必要があります。

- 34

- Kafka クラスターのリバランス に使用される Cruise Control の任意設定。

リソースを作成または更新します。

oc apply -f <kafka_configuration_file>

2.2.2. Entity Operator の設定

Entity Operator は、実行中の Kafka クラスターで Kafka 関連のエンティティーを管理します。

Entity Operator は以下で設定されます。

- Kafka トピックを管理する Topic Operator

- Kafka ユーザーを管理する User Operator

Cluster Operator は Kafka リソース設定を介して、Kafka クラスターのデプロイ時に、上記の Operator の 1 つまたは両方を含む Entity Operator をデプロイできます。

これらの operator は、Kafka クラスターのトピックおよびユーザーを管理するために自動的に設定されます。Topic Operator と User Operator は、1 つの名前空間のみを監視できます。詳細は、「AMQ Streams Operator を使用した名前空間の監視」 を参照してください。

デプロイされると、デプロイメント設定に応じて、Entity Operator pod に operator が含まれます。

2.2.2.1. Entity Operator の設定プロパティー

Kafka.spec の entityOperator プロパティーを使用して Entity Operator を設定します。

entityOperator プロパティーでは複数のサブプロパティーがサポートされます。

-

tlsSidecar -

topicOperator -

userOperator -

template

tlsSidecar プロパティーには、ZooKeeper との通信に使用される TLS サイドカーコンテナーの設定が含まれます。

template プロパティーには、ラベル、アノテーション、アフィニティー、および容認 (Toleration) などの Entity Operator Pod の設定が含まれます。テンプレートの設定に関する詳細は、「OpenShift リソースのカスタマイズ」 を参照してください。

topicOperator プロパティーには、Topic Operator の設定が含まれます。このオプションがないと、Entity Operator は Topic Operator なしでデプロイされます。

userOperator プロパティーには、User Operator の設定が含まれます。このオプションがないと、Entity Operator は User Operator なしでデプロイされます。

Entity Operator の設定に使用されるプロパティーに関する詳細は EntityUserOperatorSpec schema reference を参照してください。

両方の Operator を有効にする基本設定の例

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

name: my-cluster

spec:

kafka:

# ...

zookeeper:

# ...

entityOperator:

topicOperator: {}

userOperator: {}

topicOperator および userOperator に空のオブジェクト ({}) が使用された場合、すべてのプロパティーでデフォルト値が使用されます。

topicOperator および userOperator プロパティーの両方がない場合、Entity Operator はデプロイされません。

2.2.2.2. Topic Operator 設定プロパティー

Topic Operator デプロイメントは、topicOperator オブジェクト内で追加オプションを使用すると設定できます。以下のプロパティーがサポートされます。

watchedNamespace-

Topic Operator が

KafkaTopicリソースを監視する OpenShift 名前空間。デフォルトは、Kafka クラスターがデプロイされた namespace です。 reconciliationIntervalSeconds-

定期的な調整 (reconciliation) の間隔 (秒単位)。デフォルトは

120です。 zookeeperSessionTimeoutSeconds-

ZooKeeper セッションのタイムアウト (秒単位)。デフォルトは

18です。 topicMetadataMaxAttempts-

Kafka からトピックメタデータの取得を試行する回数。各試行の間隔は、指数バックオフとして定義されます。パーティションまたはレプリカの数によって、トピックの作成に時間がかかる可能性がある場合は、この値を大きくすることを検討してください。デフォルトは

6です。 image-

imageプロパティーを使用すると、使用されるコンテナーイメージを設定できます。カスタムコンテナーイメージの設定に関する詳細は、「image」 を参照してください。 resources-

resourcesプロパティーを使用すると、Topic Operator に割り当てられるリソースの量を設定できます。リソースの要求と制限の設定に関する詳細は、「resources」 を参照してください。 logging-

loggingプロパティーは、Topic Operator のロギングを設定します。詳細は 「logging」 を参照してください。

Topic Operator の設定例

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

name: my-cluster

spec:

kafka:

# ...

zookeeper:

# ...

entityOperator:

# ...

topicOperator:

watchedNamespace: my-topic-namespace

reconciliationIntervalSeconds: 60

# ...2.2.2.3. User Operator 設定プロパティー

User Operator デプロイメントは、userOperator オブジェクト内で追加オプションを使用すると設定できます。以下のプロパティーがサポートされます。

watchedNamespace-

User Operator が

KafkaUserリソースを監視する OpenShift 名前空間。デフォルトは、Kafka クラスターがデプロイされた namespace です。 reconciliationIntervalSeconds-

定期的な調整 (reconciliation) の間隔 (秒単位)。デフォルトは

120です。 image-

imageプロパティーを使用すると、使用されるコンテナーイメージを設定できます。カスタムコンテナーイメージの設定に関する詳細は、「image」 を参照してください。 resources-

resourcesプロパティーを使用すると、User Operator に割り当てられるリソースの量を設定できます。リソースの要求と制限の設定に関する詳細は、「resources」 を参照してください。 logging-

loggingプロパティーは、User Operator のロギングを設定します。詳細は 「logging」 を参照してください。 secretPrefix-

secretPrefixプロパティーは、KafkaUser リソースから作成されたすべての Secret の名前に接頭辞を追加します。たとえば、secretPrefix: kafka-は、すべてのシークレット名の前にkafka-を付けます。そのため、my-userという名前の KafkaUser は、kafka-my-userという名前の Secret を作成します。

User Operator の設定例

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

name: my-cluster

spec:

kafka:

# ...

zookeeper:

# ...

entityOperator:

# ...

userOperator:

watchedNamespace: my-user-namespace

reconciliationIntervalSeconds: 60

# ...2.2.3. Kafka および ZooKeeper ストレージの設定

Kafka および ZooKeeper はステートフルなアプリケーションであるため、データをディスクに格納します。AMQ Streams では、3 つのタイプのストレージがサポートされます。

- 一時データストレージ (開発用のみで推奨されます)

- 永続データストレージ

- JBOD (ZooKeeper ではなく Kafka のみ)

Kafka リソースを設定する場合、Kafka ブローカーおよび対応する ZooKeeper ノードで使用されるストレージのタイプを指定できます。以下のリソースの storage プロパティーを使用して、ストレージタイプを設定します。

-

Kafka.spec.kafka -

Kafka.spec.zookeeper

ストレージタイプは type フィールドで設定されます。

ストレージ設定プロパティーの詳細は、スキーマリファレンスを参照してください。

Kafka クラスターをデプロイした後に、ストレージタイプを変更することはできません。

2.2.3.1. データストレージに関する留意事項

AMQ Streams がうまく機能するには、効率的なデータストレージインフラストラクチャーが不可欠です。ブロックストレージが必要です。NFS などのファイルストレージは、Kafka では機能しません。

ブロックストレージには、以下のいずれかのオプションを選択します。

- Amazon Elastic Block Store (EBS) などのクラウドベースのブロックストレージソリューション。

- ローカル永続ボリューム を使用した永続ストレージ

- ファイバーチャネル や iSCSI などのプロトコルがアクセスする SAN (ストレージエリアネットワーク) ボリューム。

AMQ Streams には OpenShift の raw ブロックボリュームは必要ありません。

2.2.3.1.1. ファイルシステム

Kafka は、メッセージの保存にファイルシステムを使用します。AMQ Streams は、Kafka で一般的に使用される XFS および ext4 ファイルシステムと互換性があります。ファイルシステムを選択して設定するときは、デプロイメントの基盤となるアーキテクチャーと要件を考慮してください。

詳細については、Kafka ドキュメントの Filesystem Selection を参照してください。

2.2.3.1.2. ディスク使用率

Apache Kafka と ZooKeeper には別々のディスクを使用します。

ソリッドステートドライブ (SSD) は必須ではありませんが、複数のトピックに対してデータが非同期的に送受信される大規模なクラスターで Kafka のパフォーマンスを向上させることができます。SSD は、高速で低レイテンシーのデータアクセスが必要な ZooKeeper で特に有効です。

Kafka と ZooKeeper の両方にデータレプリケーションが組み込まれているため、複製されたストレージのプロビジョニングは必要ありません。

2.2.3.2. 一時ストレージ

一時データストレージは一時的なものです。ノード上のすべての Pod は、ローカルの一時ストレージスペースを共有します。データは、それを使用する Pod が実行されている限り保持されます。Pod が削除されると、データは失われます。ただし、Pod は高可用性環境でデータを回復できます。

その一時的な性質のため、一時ストレージは開発とテストにのみ推奨されます。

一時ストレージは emptyDir ボリュームを使用してデータを保存します。Pod がノードに割り当てられると、emptyDir ボリュームが作成されます。sizeLimit プロパティーを使用して、emptyDir のストレージの合計量を設定できます。

一時ストレージは、単一ノードの ZooKeeper クラスターやレプリケーション係数が 1 の Kafka トピックでの使用には適していません。

一時ストレージを使用するには、Kafka または ZooKeeper リソースのストレージタイプ設定を ephemeral に設定します。

一時ストレージ設定の例

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

name: my-cluster

spec:

kafka:

# ...

storage:

type: ephemeral

# ...

zookeeper:

# ...

storage:

type: ephemeral

# ...2.2.3.2.1. Kafka ログディレクトリーのマウントパス

一時ボリュームは、以下のパスにマウントされるログディレクトリーとして Kafka ブローカーによって使用されます。

/var/lib/kafka/data/kafka-logIDX

IDX は、Kafka ブローカー Pod インデックスです。たとえば、/var/lib/kafka/data/kafka-log0 のようになります。

2.2.3.3. 永続ストレージ

永続的なデータストレージは、システムが中断した場合でもデータを保持します。永続的なデータストレージを使用する Pod の場合、データは Pod の障害や再起動後も保持されます。

動的プロビジョニングフレームワークにより、永続的なストレージを使用してクラスターを作成できます。Pod 設定では、永続ボリューム要求 (PVC) を使用して、永続ボリューム (PV) でストレージ要求を行います。PV は、ストレージボリュームを表すストレージリソースです。PV は、それを使用する Pod から独立しています。PVC は、Pod の作成時に必要なストレージの量を要求します。PV の基盤となるストレージインフラストラクチャーを理解する必要はありません。PV がストレージ基準に一致する場合、PVC は PV にバインドされます。

永続的な性質のため、本番環境には永続ストレージをお勧めします。

PVC は、StorageClass を指定することにより、さまざまなタイプの永続ストレージを要求できます。ストレージクラスはストレージプロファイルを定義し、PV を動的にプロビジョニングします。ストレージクラスが指定されていない場合、デフォルトのストレージクラスが使用されます。永続ストレージオプションには、SAN ストレージタイプまたは ローカル永続ボリューム が含まれる場合があります。

永続ストレージを使用するには、Kafka または ZooKeeper リソースのストレージタイプ設定を persistent-claim に設定します。

本番環境では、次の設定が推奨されます。

-

Kafka の場合、

type: jbodを 1 つ以上のtype: persistent-claimボリュームで設定します -

ZooKeeper の場合は、

type: persistent-claimを設定します。

永続ストレージには、次の設定オプションもあります。

id(任意)-

ストレージ ID 番号。このオプションは、JBOD ストレージ宣言で定義されるストレージボリュームには必須です。デフォルトは

0です。 size(必須)- 永続ボリューム要求のサイズ (例: 1000Gi)。

class(任意)-

動的ボリュームプロビジョニングに使用する OpenShift の ストレージクラス。ストレージ

classの設定には、ボリュームのプロファイルを詳細に記述するパラメーターが含まれます。 selector(任意)- 特定の PV を指定する設定。選択したボリュームのラベルを表す key:value ペアを提供します。

deleteClaim(任意)-

クラスターのアンインストール時に PVC を削除するかどうかを指定するブール値。デフォルトは

falseです。

既存の AMQ Streams クラスターで永続ボリュームのサイズを増やすことは、永続ボリュームのサイズ変更をサポートする OpenShift バージョンでのみサポートされます。サイズを変更する永続ボリュームには、ボリューム拡張をサポートするストレージクラスを使用する必要があります。ボリューム拡張をサポートしないその他のバージョンの OpenShift およびストレージクラスでは、クラスターをデプロイする前に必要なストレージサイズを決定する必要があります。既存の永続ボリュームのサイズを縮小することはできません。

Kafka と ZooKeeper の永続ストレージ設定の例

# ...

spec:

kafka:

# ...

storage:

type: jbod

volumes:

- id: 0

type: persistent-claim

size: 100Gi

deleteClaim: false

- id: 1

type: persistent-claim

size: 100Gi

deleteClaim: false

- id: 2

type: persistent-claim

size: 100Gi

deleteClaim: false

# ...

zookeeper:

storage:

type: persistent-claim

size: 1000Gi

# ...ストレージクラスを指定しない場合、デフォルトが使用されます。次の例では、ストレージクラスを指定します。

特定のストレージクラスを使用した永続ストレージ設定の例

# ...

storage:

type: persistent-claim

size: 1Gi

class: my-storage-class

# ...

selector を使用して、SSD などの特定の機能を提供するラベル付き永続ボリュームを指定します。

セレクターを使用した永続ストレージ設定の例

# ...

storage:

type: persistent-claim

size: 1Gi

selector:

hdd-type: ssd

deleteClaim: true

# ...2.2.3.3.1. ストレージクラスのオーバーライド

デフォルトのストレージクラスを使用する代わりに、1 つ以上の Kafka ブローカー または ZooKeeper ノードに異なるストレージクラスを指定できます。これは、ストレージクラスが、異なるアベイラビリティーゾーンやデータセンターに制限されている場合などに便利です。この場合、overrides フィールドを使用できます。

以下の例では、デフォルトのストレージクラスの名前は my-storage-class になります。

ストレージクラスのオーバーライドを使用した AMQ Streams クラスターの例

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

labels:

app: my-cluster

name: my-cluster

namespace: myproject

spec:

# ...

kafka:

replicas: 3

storage:

type: jbod

volumes:

- id: 0

type: persistent-claim

size: 100Gi

deleteClaim: false

class: my-storage-class

overrides:

- broker: 0

class: my-storage-class-zone-1a

- broker: 1

class: my-storage-class-zone-1b

- broker: 2

class: my-storage-class-zone-1c

# ...

# ...

zookeeper:

replicas: 3

storage:

deleteClaim: true

size: 100Gi

type: persistent-claim

class: my-storage-class

overrides:

- broker: 0

class: my-storage-class-zone-1a

- broker: 1

class: my-storage-class-zone-1b

- broker: 2

class: my-storage-class-zone-1c

# ...

overrides プロパティーが設定され、ボリュームによって以下のストレージクラスが使用されます。

-

ZooKeeper ノード 0 の永続ボリュームでは

my-storage-class-zone-1aが使用されます。 -

ZooKeeper ノード 1 の永続ボリュームでは

my-storage-class-zone-1bが使用されます。 -

ZooKeeepr ノード 2 の永続ボリュームでは

my-storage-class-zone-1cが使用されます。 -

Kafka ブローカー 0 の永続ボリュームでは

my-storage-class-zone-1aが使用されます。 -

Kafka ブローカー 1 の永続ボリュームでは

my-storage-class-zone-1bが使用されます。 -

Kafka ブローカー 2 の永続ボリュームでは

my-storage-class-zone-1cが使用されます。

現在、overrides プロパティーは、ストレージクラスの設定をオーバーライドするためのみに使用されます。他のストレージ設定プロパティーのオーバーライドは現在サポートされていません。他のストレージ設定プロパティーは現在サポートされていません。

2.2.3.3.2. 永続ストレージ用の PVC リソース

永続ストレージを使用すると、次の名前で PVC が作成されます。

data-cluster-name-kafka-idx-

Kafka ブローカー Pod

idxのデータを格納するために使用されるボリュームの PVC。 data-cluster-name-zookeeper-idx-

ZooKeeper ノード Pod

idxのデータを格納するために使用されるボリュームの PVC。

2.2.3.3.3. Kafka ログディレクトリーのマウントパス

永続ボリュームは、以下のパスにマウントされるログディレクトリーとして Kafka ブローカーによって使用されます。

/var/lib/kafka/data/kafka-logIDX

IDX は、Kafka ブローカー Pod インデックスです。たとえば、/var/lib/kafka/data/kafka-log0 のようになります。

2.2.3.4. 永続ボリュームのサイズ変更

既存の AMQ Streams クラスターによって使用される永続ボリュームのサイズを増やすことで、ストレージ容量を増やすことができます。永続ボリュームのサイズ変更は、JBOD ストレージ設定で 1 つまたは複数の永続ボリュームが使用されるクラスターでサポートされます。

永続ボリュームのサイズを拡張することはできますが、縮小することはできません。永続ボリュームのサイズ縮小は、現在 OpenShift ではサポートされていません。

前提条件

- ボリュームのサイズ変更をサポートする OpenShift クラスター。

- Cluster Operator が稼働中です。

- ボリューム拡張をサポートするストレージクラスを使用して作成された永続ボリュームを使用する Kafka クラスター。

手順

クラスターの

Kafkaリソースを編集します。sizeプロパティーを変更して、Kafka クラスター、ZooKeeper クラスター、またはその両方に割り当てられた永続ボリュームのサイズを増やします。-

Kafka クラスターの場合は、

spec.kafka.storageの下にあるsizeプロパティーを更新します。 -

ZooKeeper クラスターの場合は、

spec.zookeeper.storageの下にあるsizeプロパティーを更新します。

ボリュームサイズを

2000Giに増やす Kafka 設定apiVersion: kafka.strimzi.io/v1beta2 kind: Kafka metadata: name: my-cluster spec: kafka: # ... storage: type: persistent-claim size: 2000Gi class: my-storage-class # ... zookeeper: # ...-

Kafka クラスターの場合は、

リソースを作成または更新します。

oc apply -f <kafka_configuration_file>OpenShift では、Cluster Operator からの要求に応じて、選択された永続ボリュームの容量が増やされます。サイズ変更が完了すると、サイズ変更された永続ボリュームを使用するすべての Pod が Cluster Operator によって再起動されます。これは自動的に行われます。

クラスター上の関連する Pod のストレージ容量が増加したことを確認します。

oc get pvストレージが増加した Kafka ブローカー Pod

NAME CAPACITY CLAIM pvc-0ca459ce-... 2000Gi my-project/data-my-cluster-kafka-2 pvc-6e1810be-... 2000Gi my-project/data-my-cluster-kafka-0 pvc-82dc78c9-... 2000Gi my-project/data-my-cluster-kafka-1出力には、ブローカー Pod に関連付けられた各 PVC の名前が表示されます。

2.2.3.5. JBOD ストレージ

AMQ Streams で、複数のディスクやボリュームのデータストレージ設定である JBOD を使用するように設定できます。JBOD は、Kafka ブローカーのデータストレージを増やす方法の 1 つです。また、パフォーマンスを向上することもできます。

JBOD ストレージは Kafka でのみ サポートされ、ZooKeeper ではサポートされません。

JBOD 設定は 1 つ以上のボリュームによって記述され、各ボリュームは 一時 または 永続 ボリュームのいずれかになります。JBOD ボリューム宣言のルールおよび制約は、一時および永続ストレージのルールおよび制約と同じです。たとえば、プロビジョニング後に永続ストレージのボリュームのサイズを縮小することはできません。また、タイプが ephemeral の場合は、sizeLimit の値を変更することはできません。

JBOD ストレージを使用するには、Kafka リソースのストレージタイプ設定を jbod に設定します。volumes プロパティーを使用すると、JBOD ストレージアレイまたは設定を設定するディスクを記述できます。

JBOD ストレージ設定の例

# ...

storage:

type: jbod

volumes:

- id: 0

type: persistent-claim

size: 100Gi

deleteClaim: false

- id: 1

type: persistent-claim

size: 100Gi

deleteClaim: false

# ...JBOD ボリュームが作成されると、ID を変更することはできません。JBOD 設定からボリュームを追加または削除できます。

2.2.3.5.1. JBOD ストレージの PVC リソース

永続ストレージを使用して JBOD ボリュームを宣言すると、次の名前の PVC が作成されます。

data-id-cluster-name-kafka-idx-

Kafka ブローカー Pod

idxのデータを格納するために使用されるボリュームの PVC。idは、Kafka ブローカー Pod のデータを格納するために使用されるボリュームの ID になります。

2.2.3.5.2. Kafka ログディレクトリーのマウントパス

JBOD ボリュームは、以下のパスにマウントされるログディレクトリーとして Kafka ブローカーによって使用されます。

/var/lib/kafka/data-id/kafka-logidx

id は、Kafka ブローカー Pod idx のデータを保存するために使用されるボリュームの ID に置き換えます。たとえば、/var/lib/kafka/data-0/kafka-log0 のようになります。

2.2.3.6. JBOD ストレージへのボリュームの追加

この手順では、JBOD ストレージを使用するように設定されている Kafka クラスターにボリュームを追加する方法を説明します。この手順は、他のストレージタイプを使用するように設定されている Kafka クラスターには適用できません。

以前使用され、削除された id の下に新規ボリュームを追加する場合、以前使用された PersistentVolumeClaims が必ず削除されているよう確認する必要があります。

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator

- JBOD ストレージのある Kafka クラスター。

手順

Kafkaリソースのspec.kafka.storage.volumesプロパティーを編集します。新しいボリュームをvolumesアレイに追加します。たとえば、id が2の新しいボリュームを追加します。apiVersion: kafka.strimzi.io/v1beta2 kind: Kafka metadata: name: my-cluster spec: kafka: # ... storage: type: jbod volumes: - id: 0 type: persistent-claim size: 100Gi deleteClaim: false - id: 1 type: persistent-claim size: 100Gi deleteClaim: false - id: 2 type: persistent-claim size: 100Gi deleteClaim: false # ... zookeeper: # ...リソースを作成または更新します。

oc apply -f <kafka_configuration_file>- 新しいトピックを作成するか、既存のパーティションを新しいディスクに再度割り当てます。

2.2.3.7. JBOD ストレージからのボリュームの削除

この手順では、JBOD ストレージを使用するように設定されている Kafka クラスターからボリュームを削除する方法を説明します。この手順は、他のストレージタイプを使用するように設定されている Kafka クラスターには適用できません。JBOD ストレージには、常に 1 つのボリュームが含まれている必要があります。

データの損失を避けるには、ボリュームを削除する前にすべてのパーティションを移動する必要があります。

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator

- 複数のボリュームがある JBOD ストレージのある Kafka クラスター

手順

- 削除するディスクからすべてのパーティションを再度割り当てます。削除するディスクに割り当てられたままになっているパーティションのデータは削除される可能性があります。

Kafkaリソースのspec.kafka.storage.volumesプロパティーを編集します。volumesアレイから 1 つまたは複数のボリュームを削除します。たとえば、ID が1と2のボリュームを削除します。apiVersion: kafka.strimzi.io/v1beta2 kind: Kafka metadata: name: my-cluster spec: kafka: # ... storage: type: jbod volumes: - id: 0 type: persistent-claim size: 100Gi deleteClaim: false # ... zookeeper: # ...リソースを作成または更新します。

oc apply -f <kafka_configuration_file>

2.2.4. クラスターのスケーリング

ブローカーを追加または削除して、Kafka クラスターをスケーリングします。クラスターにトピックがすでに定義されている場合は、パーティションを再度割り当てる必要があります。

kafka-reassign-partitions.sh ツールを使用して、パーティションを再度割り当てます。このツールは、再割り当てを行うトピックを指定する再割り当て JSON ファイルを使用します。

特定のパーティションを移動させたい場合は、再割り当て JSON ファイルを生成するか、手動でファイルを作成します。

2.2.4.1. ブローカーのスケーリング設定

Kafka.spec.kafka.replicas の設定を行い、ブローカーの数を追加または削減します。

ブローカーの追加

トピックのスループットを向上させる主な方法は、そのトピックのパーティション数を増やすことです。これにより、追加のパーティションによってクラスター内の異なるブローカー間でトピックの負荷が共有されます。ただし、各ブローカーが特定のリソース (通常は I/O) によって制約される場合、パーティションを増やしてもスループットは向上しません。代わりに、ブローカーをクラスターに追加する必要があります。

ブローカーをクラスターに追加する場合、Kafka ではパーティションは自動的に割り当てられません。どのパーティションを既存のブローカーから新しいブローカーに再割り当てするかを決めなければなりません。

すべてのブローカーの間でパーティションが再分配されると、各ブローカーのリソース使用量が減少します。

ブローカーの削除

StatefulSets を使用してブローカー Pod を管理する場合、クラスターから任意の Pod を削除することはできません。クラスターから削除できるのは、番号が最も大きい 1 つまたは複数の Pod のみです。たとえば、12 個のブローカーがあるクラスターでは、Pod の名前は cluster-name-kafka-0 から cluster-name-kafka-11 になります。1 つのブローカー分をスケールダウンする場合、cluster-name-kafka-11 が削除されます。

クラスターからブローカーを削除する前に、そのブローカーにパーティションが割り当てられていないことを確認します。また、使用が停止されたブローカーの各パーティションを引き継ぐ、残りのブローカーを決める必要もあります。ブローカーに割り当てられたパーティションがなければ、クラスターを安全にスケールダウンできます。

2.2.4.2. パーティション再割り当てツール

現在、Topic Operator は別のブローカーへのレプリカの再割り当てをサポートしていないため、ブローカー Pod に直接接続してレプリカをブローカーに再度割り当てる必要があります。

ブローカー Pod 内では、kafka-reassign-partitions.sh ツールを使用して、パーティションを異なるブローカーに再度割り当てることができます。

これには、以下の 3 つのモードがあります。

--generate- トピックとブローカーのセットを取得し、再割り当て JSON ファイル を生成します。これにより、トピックのパーティションがブローカーに割り当てられます。これはトピック全体で動作するため、一部のトピックのパーティションを再度割り当てる場合は使用できません。

--execute- 再割り当て JSON ファイル を取得し、クラスターのパーティションおよびブローカーに適用します。その結果、パーティションを取得したブローカーは、パーティションリーダーのフォロワーになります。新規ブローカーが ISR (同期レプリカ) に参加できたら、古いブローカーはフォロワーではなくなり、そのレプリカが削除されます。

--verify-

--verifyは、--executeステップと同じ 再割り当て JSON ファイル を使用して、ファイル内のすべてのパーティションが目的のブローカーに移動されたかどうかをチェックします。再割り当てが完了すると、--verifyは有効なトラフィックスロットル (--throttle) も削除します。スロットルを削除しないと、再割り当てが完了した後もクラスターは影響を受け続けます。

クラスターでは、1 度に 1 つの再割り当てのみを実行でき、実行中の再割り当てをキャンセルすることはできません。再割り当てをキャンセルする必要がある場合は、割り当てが完了するのを待ってから別の再割り当てを実行し、最初の再割り当ての結果を元に戻します。kafka-reassign-partitions.sh によって、元に戻すための再割り当て JSON が出力の一部として生成されます。大規模な再割り当ては、進行中の再割り当てを停止する必要がある場合に備えて、複数の小さな再割り当てに分割するようにしてください。

2.2.4.2.1. パーティション再割り当ての JSON ファイル

再割り当て JSON ファイル には特定の構造があります。

{

"version": 1,

"partitions": [

<PartitionObjects>

]

}ここで <PartitionObjects> は、以下のようなコンマ区切りのオブジェクトリストになります。

{

"topic": <TopicName>,

"partition": <Partition>,

"replicas": [ <AssignedBrokerIds> ]

}

Kafka は "log_dirs" プロパティーもサポートしますが、AMQ Streams では使用しないでください。

以下は、トピック topic-a のパーティション 4 をブローカー 2、4、7 に割り当て、トピック topic-b のパーティション 2 をブローカー 1、5、7 に割り当てる再割り当て JSON ファイルの例です。

パーティション再割り当てファイルの例

{

"version": 1,

"partitions": [

{

"topic": "topic-a",

"partition": 4,

"replicas": [2,4,7]

},

{

"topic": "topic-b",

"partition": 2,

"replicas": [1,5,7]

}

]

}JSON に含まれていないパーティションは変更されません。

2.2.4.2.2. JBOD ボリューム間のパーティション再割り当て

Kafka クラスターで JBOD ストレージを使用する場合は、特定のボリュームとログディレクトリー (各ボリュームに単一のログディレクトリーがある) との間でパーティションの再割り当てを選択することができます。パーティションを特定のボリュームに再割り当てするには、再割り当て JSON ファイルで log_dirs オプションを <PartitionObjects> に追加します。

{

"topic": <TopicName>,

"partition": <Partition>,

"replicas": [ <AssignedBrokerIds> ],

"log_dirs": [ <AssignedLogDirs> ]

}

log_dirs オブジェクトに含まれるログディレクトリーの数は、replicas オブジェクトで指定されるレプリカ数と同じである必要があります。値は、ログディレクトリーへの絶対パスか、any キーワードである必要があります。

ログディレクトリーを指定するパーティション再割り当てファイルの例

{

"topic": "topic-a",

"partition": 4,

"replicas": [2,4,7].

"log_dirs": [ "/var/lib/kafka/data-0/kafka-log2", "/var/lib/kafka/data-0/kafka-log4", "/var/lib/kafka/data-0/kafka-log7" ]

}パーティション再割り当てスロットリングの適用

パーティションの再割り当てには、ブローカーの間で大量のデータを転送する必要があるため、処理が遅くなる可能性があります。クライアントへの悪影響を防ぐため、再割り当て処理をススロットルできます。--throttle パラメーターを kafka-reassign-partitions.sh ツールと共に使用して、再割り当てをスロットルします。ブローカー間のパーティションの移動の最大しきい値をバイト単位で指定します。たとえば --throttle 5000000 は、パーティションを移動する最大しきい値を 50 MBps に設定します。

スロットリングにより、再割り当ての完了に時間がかかる場合があります。

- スロットルが低すぎると、新たに割り当てられたブローカーは公開されるレコードに対応できず、再割り当ては完了しません。

- スロットルが高すぎると、クライアントに影響します。

たとえば、プロデューサーの場合は、確認応答を待つ通常のレイテンシーよりも高い可能性があります。コンシューマーの場合は、ポーリング間のレイテンシーが大きいことが原因でスループットが低下する可能性があります。

2.2.4.3. 再割り当て JSON ファイルの生成

この手順では、再割り当て JSON ファイルを生成する方法を説明します。kafka-reassign-partitions.sh ツールと共に再割り当てファイルを使用して、Kafka クラスターのスケーリング後にパーティションの再割り当てを実行します。

このツールは、Kafka クラスターに接続された対話型 Pod コンテナーから実行します。

この手順では、mTLS を使用するセキュアな再割り当てプロセスを説明します。TLS 暗号化と mTLS 認証を使用する Kafka クラスターが必要です。

接続を確立するには、次のものが必要です。

- Kafka クラスターの作成時に Cluster Operator によって生成されたクラスター CA 証明書とパスワード

- ユーザーが Kafka クラスターへのクライアントアクセス用に作成されたときに User Operator によって生成されたユーザー CA 証明書とパスワード

この手順では、CA 証明書と対応するパスワードが、PKCS #12 (.p12 および .password) 形式で含まれているクラスターとユーザーシークレットから抽出されます。パスワードは、証明書を含む .p12 ストアへのアクセスを許可します。.p12 ストアを使用してトラストストアとキーストアを指定し、Kafka クラスターへの接続を認証します。

前提条件

- Cluster Operator が実行中である。

内部 TLS 暗号化と mTLS 認証で設定された

Kafkaリソースに基づいて実行中の Kafka クラスターがあります。TLS 暗号化と mTLS 認証を使用した Kafka 設定

apiVersion: kafka.strimzi.io/v1beta2 kind: Kafka metadata: name: my-cluster spec: kafka: # ... listeners: # ... - name: tls port: 9093 type: internal tls: true1 authentication: type: tls2 # ...- 1

- 内部リスナーの TLS 暗号化を有効にします。

- 2

- 相互

tlsとして指定されたリスナー認証メカニズム。

稼働中の Kafka クラスターには、再割り当てするトピックおよびパーティションのセットが含まれます。

my-topicのトピック設定例apiVersion: kafka.strimzi.io/v1beta2 kind: KafkaTopic metadata: name: my-topic labels: strimzi.io/cluster: my-cluster spec: partitions: 10 replicas: 3 config: retention.ms: 7200000 segment.bytes: 1073741824 # ...Kafka ブローカーからトピックを生成および使用するパーミッションを指定する ACL ルールとともに

KafkaUserが設定されています。my-topicおよびmy-clusterでの操作を許可する ACL ルールを使用した Kafka ユーザーの設定例apiVersion: kafka.strimzi.io/v1beta2 kind: KafkaUser metadata: name: my-user labels: strimzi.io/cluster: my-cluster spec: authentication:1 type: tls authorization: type: simple2 acls: # access to the topic - resource: type: topic name: my-topic operations: - Create - Describe - Read - AlterConfigs host: "*" # access to the cluster - resource: type: cluster operations: - Alter - AlterConfigs host: "*" # ... # ...

手順

Kafka クラスターの

<cluster_name>-cluster-ca-certシークレットからクラスター CA 証明書とパスワードを抽出します。oc get secret <cluster_name>-cluster-ca-cert -o jsonpath='{.data.ca\.p12}' | base64 -d > ca.p12oc get secret <cluster_name>-cluster-ca-cert -o jsonpath='{.data.ca\.password}' | base64 -d > ca.password<cluster_name> は、Kafka クラスターの名前に置き換えます。

Kafkaリソースを使用して Kafka をデプロイすると、Kafka クラスター名 (<cluster_name>-cluster-ca-cert) でクラスター CA 証明書のシークレットが作成されます。例:my-cluster-cluster-ca-certAMQ Streams の Kafka イメージを使用してインタラクティブな Pod コンテナーを新たに実行し、稼働中の Kafka ブローカーに接続します。

oc run --restart=Never --image=registry.redhat.io/amq7/amq-streams-kafka-33-rhel8:2.3.0 <interactive_pod_name> -- /bin/sh -c "sleep 3600"<interactive_pod_name> は Pod の名前に置き換えます。

クラスター CA 証明書をインタラクティブな Pod コンテナーにコピーします。

oc cp ca.p12 <interactive_pod_name>:/tmpKafka ブローカーへのアクセス権限を持つ Kafka ユーザーのシークレットから、ユーザー CA 証明書およびパスワードを抽出します。

oc get secret <kafka_user> -o jsonpath='{.data.user\.p12}' | base64 -d > user.p12oc get secret <kafka_user> -o jsonpath='{.data.user\.password}' | base64 -d > user.password<kafka_user> は Kafka ユーザーの名前に置き換えます。

KafkaUserリソースを使用して Kafka ユーザーを作成すると、ユーザー CA 証明書のあるシークレットが Kafka ユーザー名で作成されます。例:my-userユーザー CA 証明書をインタラクティブな Pod コンテナーにコピーします。

oc cp user.p12 <interactive_pod_name>:/tmpCA 証明書を使用すると、インタラクティブな Pod コンテナーが TLS を使用して Kafka ブローカーに接続できます。

config.propertiesファイルを作成し、Kafka クラスターへの認証に使用されるトラストストアおよびキーストアを指定します。前の手順で展開した証明書とパスワードを使用します。

bootstrap.servers=<kafka_cluster_name>-kafka-bootstrap:90931 security.protocol=SSL2 ssl.truststore.location=/tmp/ca.p123 ssl.truststore.password=<truststore_password>4 ssl.keystore.location=/tmp/user.p125 ssl.keystore.password=<keystore_password>6 - 1

- Kafka クラスターに接続するためのブートストラップサーバーアドレス。独自の Kafka クラスター名を使用して、<kafka_cluster_name> を置き換えます。

- 2

- 暗号化に TLS を使用する場合のセキュリティープロトコルオプション。

- 3

- トラストストアの場所には、Kafka クラスターの公開鍵証明書 (

ca.p12) が含まれます。 - 4

- トラストストアにアクセスするためのパスワード (

ca.password)。 - 5

- キーストアの場所には、Kafka ユーザーの公開鍵証明書 (

user.p12) が含まれます。 - 6

- キーストアにアクセスするためのパスワード (

user.password)。

config.propertiesファイルをインタラクティブな Pod コンテナーにコピーします。oc cp config.properties <interactive_pod_name>:/tmp/config.properties移動するトピックを指定する

topics.jsonという名前の JSON ファイルを準備します。トピック名をコンマ区切りの一覧として指定します。

topic-aおよびtopic-bのすべてのパーティションを再割り当てする JSON ファイルの例{ "version": 1, "topics": [ { "topic": "topic-a"}, { "topic": "topic-b"} ] }topics.jsonファイルをインタラクティブな Pod コンテナーにコピーします。oc cp topics.json <interactive_pod_name>:/tmp/topics.jsonインタラクティブな Pod コンテナーでシェルプロセスを開始します。

oc exec -n <namespace> -ti <interactive_pod_name> /bin/bash<namespace> を Pod が実行されている OpenShift namespace に置き換えます。

kafka-reassign-partitions.shコマンドを使用して、再割り当て JSON を生成します。topic-aとtopic-bのすべてのパーティションをブローカー0、1、2に移動させるコマンド例bin/kafka-reassign-partitions.sh --bootstrap-server my-cluster-kafka-bootstrap:9093 \ --command-config /tmp/config.properties \ --topics-to-move-json-file /tmp/topics.json \ --broker-list 0,1,2 \ --generate

2.2.4.4. Kafka クラスターのスケールアップ

再割り当てファイルを使用して、Kafka クラスター内のブローカーの数を増やします。

再割り当てファイルには、拡大された Kafka クラスター内のブローカーにパーティションを再度割り当てる方法を記述する必要があります。

この手順では、TLS を使用する安全なスケーリングプロセスについて説明します。TLS 暗号化と mTLS 認証を使用する Kafka クラスターが必要です。

前提条件

-

内部 TLS 暗号化と mTLS 認証で設定された

Kafkaリソースに基づいて実行中の Kafka クラスターがあります。 -

reassignment.jsonという名前の再割り当て JSON ファイルを生成している。 - 実行中の Kafka ブローカーに接続されている対話型 Pod コンテナーを実行している。

-

KafkaUserとして接続されている。このユーザーは、Kafka クラスターとそのトピックの管理権限を指定する ACL ルールで設定されている。

再割り当て JSON ファイルの生成 を参照してください。

手順

-

kafka.spec.kafka.replicas設定オプションを増やして、新しいブローカーを必要なだけ追加します。 - 新しいブローカー Pod が起動したことを確認します。

-

まだ確認していない場合には、インタラクティブな Pod コンテナーを実行 して

reassignment.jsonという名前の再割り当てJSONファイルを生成します。 reassignment.jsonファイルをインタラクティブな Pod コンテナーにコピーします。oc cp reassignment.json <interactive_pod_name>:/tmp/reassignment.json<interactive_pod_name> は Pod の名前に置き換えます。

インタラクティブな Pod コンテナーでシェルプロセスを開始します。

oc exec -n <namespace> -ti <interactive_pod_name> /bin/bash<namespace> を Pod が実行されている OpenShift namespace に置き換えます。

インタラクティブな Pod コンテナーから

kafka-reassign-partitions.shスクリプトを使用して、パーティションの再割り当てを実行します。bin/kafka-reassign-partitions.sh --bootstrap-server <cluster_name>-kafka-bootstrap:9093 \ --command-config /tmp/config.properties \ --reassignment-json-file /tmp/reassignment.json \ --execute<cluster_name> は、独自の Kafka クラスターの名前に置き換えます。例:

my-cluster-kafka-bootstrap:9093レプリケーションにスロットリングを適用する場合、

--throttleとブローカー間のスロットル率 (バイト/秒単位) を渡すこともできます。以下に例を示します。bin/kafka-reassign-partitions.sh --bootstrap-server <cluster_name>-kafka-bootstrap:9093 \ --command-config /tmp/config.properties \ --reassignment-json-file /tmp/reassignment.json \ --throttle 5000000 \ --executeこのコマンドは、2 つの再割り当て JSON オブジェクトを出力します。最初の JSON オブジェクトには、移動されたパーティションの現在の割り当てが記録されます。後で再割り当てを元に戻す必要がある場合に備え、この値をローカルファイル (Pod のファイル以外) に保存します。2 つ目の JSON オブジェクトは、再割り当て JSON ファイルに渡したターゲットの再割り当てです。

再割り当ての最中にスロットルを変更する必要がある場合は、同じコマンドに別のスロットル率を指定して実行します。以下に例を示します。

bin/kafka-reassign-partitions.sh --bootstrap-server <cluster_name>-kafka-bootstrap:9093 \ --command-config /tmp/config.properties \ --reassignment-json-file /tmp/reassignment.json \ --throttle 10000000 \ --executeブローカー Pod のいずれかから

kafka-reassign-partitions.shコマンドラインツールを使用して、再割り当てが完了したかどうかを確認します。これは先ほどの手順と同じコマンドですが、--verifyオプションの代わりに--executeオプションを使用します。bin/kafka-reassign-partitions.sh --bootstrap-server <cluster_name>-kafka-bootstrap:9093 \ --command-config /tmp/config.properties \ --reassignment-json-file /tmp/reassignment.json \ --verify--verifyコマンドによって、移動した各パーティションが正常に完了したことが報告されると、再割り当ては終了します。この最終的な--verifyによって、結果的に再割り当てスロットルも削除されます。- 割り当てを元のブローカーに戻すために JSON ファイルを保存した場合は、ここでそのファイルを削除できます。

2.2.4.5. Kafka クラスターのスケールダウン

再割り当てファイルを使用して、Kafka クラスター内のブローカーの数を減らします。

再割り当てファイルでは、Kafka クラスターの残りのブローカーにパーティションを再割り当てする方法を記述する必要があります。最も番号の大きい Pod のブローカーが最初に削除されます。

この手順では、TLS を使用する安全なスケーリングプロセスについて説明します。TLS 暗号化と mTLS 認証を使用する Kafka クラスターが必要です。

前提条件

-

内部 TLS 暗号化と mTLS 認証で設定された

Kafkaリソースに基づいて実行中の Kafka クラスターがあります。 -

reassignment.jsonという名前の再割り当て JSON ファイルを生成している。 - 実行中の Kafka ブローカーに接続されている対話型 Pod コンテナーを実行している。

-

KafkaUserとして接続されている。このユーザーは、Kafka クラスターとそのトピックの管理権限を指定する ACL ルールで設定されている。

再割り当て JSON ファイルの生成 を参照してください。

手順

-

まだ確認していない場合には、インタラクティブな Pod コンテナーを実行 して

reassignment.jsonという名前の再割り当てJSONファイルを生成します。 reassignment.jsonファイルをインタラクティブな Pod コンテナーにコピーします。oc cp reassignment.json <interactive_pod_name>:/tmp/reassignment.json<interactive_pod_name> は Pod の名前に置き換えます。

インタラクティブな Pod コンテナーでシェルプロセスを開始します。

oc exec -n <namespace> -ti <interactive_pod_name> /bin/bash<namespace> を Pod が実行されている OpenShift namespace に置き換えます。

インタラクティブな Pod コンテナーから

kafka-reassign-partitions.shスクリプトを使用して、パーティションの再割り当てを実行します。bin/kafka-reassign-partitions.sh --bootstrap-server <cluster_name>-kafka-bootstrap:9093 \ --command-config /tmp/config.properties \ --reassignment-json-file /tmp/reassignment.json \ --execute<cluster_name> は、独自の Kafka クラスターの名前に置き換えます。例:

my-cluster-kafka-bootstrap:9093レプリケーションにスロットリングを適用する場合、

--throttleとブローカー間のスロットル率 (バイト/秒単位) を渡すこともできます。以下に例を示します。bin/kafka-reassign-partitions.sh --bootstrap-server <cluster_name>-kafka-bootstrap:9093 \ --command-config /tmp/config.properties \ --reassignment-json-file /tmp/reassignment.json \ --throttle 5000000 \ --executeこのコマンドは、2 つの再割り当て JSON オブジェクトを出力します。最初の JSON オブジェクトには、移動されたパーティションの現在の割り当てが記録されます。後で再割り当てを元に戻す必要がある場合に備え、この値をローカルファイル (Pod のファイル以外) に保存します。2 つ目の JSON オブジェクトは、再割り当て JSON ファイルに渡したターゲットの再割り当てです。

再割り当ての最中にスロットルを変更する必要がある場合は、同じコマンドに別のスロットル率を指定して実行します。以下に例を示します。

bin/kafka-reassign-partitions.sh --bootstrap-server <cluster_name>-kafka-bootstrap:9093 \ --command-config /tmp/config.properties \ --reassignment-json-file /tmp/reassignment.json \ --throttle 10000000 \ --executeブローカー Pod のいずれかから

kafka-reassign-partitions.shコマンドラインツールを使用して、再割り当てが完了したかどうかを確認します。これは先ほどの手順と同じコマンドですが、--verifyオプションの代わりに--executeオプションを使用します。bin/kafka-reassign-partitions.sh --bootstrap-server <cluster_name>-kafka-bootstrap:9093 \ --command-config /tmp/config.properties \ --reassignment-json-file /tmp/reassignment.json \ --verify--verifyコマンドによって、移動した各パーティションが正常に完了したことが報告されると、再割り当ては終了します。この最終的な--verifyによって、結果的に再割り当てスロットルも削除されます。- 割り当てを元のブローカーに戻すために JSON ファイルを保存した場合は、ここでそのファイルを削除できます。

すべてのパーティションの再割り当てが終了すると、削除されるブローカーはクラスター内のいずれのパーティションにも対応しないはずです。これは、ブローカーのデータログディレクトリーにライブパーティションのログが含まれていないことを確認すると検証できます。ブローカのログディレクトリーに、拡張正規表現

\.[a-z0-9]-delete$に一致しないディレクトリーが含まれている場合、ブローカには、まだライブパーティションがあるため、停止しないでください。これを確認するには、以下のコマンドを実行します。

oc exec my-cluster-kafka-0 -c kafka -it -- \ /bin/bash -c \ "ls -l /var/lib/kafka/kafka-log_<n>_ | grep -E '^d' | grep -vE '[a-zA-Z0-9.-]+\.[a-z0-9]+-delete$'"n は削除された Pod の数に置き換えます。

上記のコマンドによって出力が生成される場合、ブローカーにはライブパーティションがあります。この場合、再割り当てが終了していないか、再割り当て JSON ファイルが適切ではありません。

-

ブローカーにライブパーティションがないことを確認できたら、

KafkaリソースのKafka.spec.kafka.replicasプロパティーを編集してブローカーの数を減らすことができます。

2.2.5. ローリング更新のメンテナーンス時間枠

メンテナーンス時間枠によって、Kafka および ZooKeeper クラスターの特定のローリング更新が便利な時間に開始されるようにスケジュールできます。

2.2.5.1. メンテナーンス時間枠の概要

ほとんどの場合、Cluster Operator は対応する Kafka リソースの変更に対応するために Kafka または ZooKeeper クラスターのみを更新します。これにより、Kafka リソースの変更を適用するタイミングを計画し、Kafka クライアントアプリケーションへの影響を最小限に抑えることができます。

ただし、Kafka リソースの変更がなくても Kafka および ZooKeeper クラスターの更新が発生することがあります。たとえば、Cluster Operator によって管理される CA (認証局) 証明書が期限切れ直前である場合にローリング再起動の実行が必要になります。

サービスの 可用性 は Pod のローリング再起動による影響を受けないはずですが (ブローカーおよびトピックの設定が適切である場合)、Kafka クライアントアプリケーションの パフォーマンス は影響を受ける可能性があります。メンテナーンス時間枠によって、Kafka および ZooKeeper クラスターのこのような自発的な更新が便利な時間に開始されるようにスケジュールできます。メンテナーンス時間枠がクラスターに設定されていない場合は、予測できない高負荷が発生する期間など、不便な時間にこのような自発的なローリング更新が行われる可能性があります。

2.2.5.2. メンテナーンス時間枠の定義

Kafka.spec.maintenanceTimeWindows プロパティーに文字列の配列を入力して、メンテナーンス時間枠を設定します。各文字列は、UTC (協定世界時、Coordinated Universal Time) であると解釈される cron 式 です。UTC は実用的にはグリニッジ標準時と同じです。

以下の例では、日、月、火、水、および木曜日の午前 0 時に開始し、午前 1 時 59 分 (UTC) に終わる、単一のメンテナーンス時間枠が設定されます。

# ...

maintenanceTimeWindows:

- "* * 0-1 ? * SUN,MON,TUE,WED,THU *"

# ...

実際には、必要な CA 証明書の更新が設定されたメンテナーンス時間枠内で完了できるように、Kafka リソースの Kafka.spec.clusterCa.renewalDays および Kafka.spec.clientsCa.renewalDays プロパティーとともにメンテナーンス期間を設定する必要があります。

AMQ Streams では、指定の期間にしたがってメンテナーンス操作を正確にスケジュールしません。その代わりに、調整ごとにメンテナーンス期間が現在オープンであるかどうかを確認します。これは、特定の時間枠内でのメンテナーンス操作の開始が、最大で Cluster Operator の調整が行われる間隔の長さ分、遅れる可能性があることを意味します。したがって、メンテナーンス時間枠は最低でもその間隔の長さにする必要があります。

2.2.5.3. メンテナーンス時間枠の設定

サポートされるプロセスによってトリガーされるローリング更新のメンテナーンス時間枠を設定できます。

前提条件

- OpenShift クラスター

- Cluster Operator が稼働中です。

手順

KafkaリソースのmaintenanceTimeWindowsプロパティー を追加または編集します。たとえば、0800 から 1059 までと、1400 から 1559 までのメンテナーンスを可能にするには、以下のようにmaintenanceTimeWindowsを設定します。apiVersion: kafka.strimzi.io/v1beta2 kind: Kafka metadata: name: my-cluster spec: kafka: # ... zookeeper: # ... maintenanceTimeWindows: - "* * 8-10 * * ?" - "* * 14-15 * * ?"リソースを作成または更新します。

oc apply -f <kafka_configuration_file>

2.2.6. ターミナルからの ZooKeeper への接続

ほとんどの Kafka CLI ツールは Kafka に直接接続できます。したがって、通常の状況では ZooKeeper に接続する必要はありません。ZooKeeper サービスは暗号化および認証でセキュア化され、AMQ Streams の一部でない外部アプリケーションでの使用は想定されていません。

ただし、ZooKeeper への接続を必要とする Kafka CLI ツールを使用する場合は、ZooKeeper コンテナー内でターミナルを使用し、ZooKeeper アドレスとして localhost:12181 に接続できます。

前提条件

- 利用可能な OpenShift クラスター

- 稼働中の Kafka クラスター

- Cluster Operator が稼働中です。

手順

OpenShift コンソールを使用してターミナルを開くか、CLI から

execコマンドを実行します。以下に例を示します。

oc exec -ti my-cluster-zookeeper-0 -- bin/kafka-topics.sh --list --zookeeper localhost:12181必ず

localhost:12181を使用してください。ZooKeeper に対して Kafka コマンドを実行できるようになりました。

2.2.7. Kafka ノードの手動による削除

この手順では、OpenShift アノテーションを使用して既存の Kafka ノードを削除する方法を説明します。Kafka ノードの削除するには、Kafka ブローカーが稼働している Pod と、関連する PersistentVolumeClaim の両方を削除します (クラスターが永続ストレージでデプロイされた場合)。削除後、Pod と関連する PersistentVolumeClaim が自動的に再作成されます。

PersistentVolumeClaim を削除すると、データが永久に失われる可能性があります。以下の手順は、ストレージで問題が発生した場合にのみ実行してください。

前提条件

以下を実行する方法については、OpenShift での AMQ Streams のデプロイおよびアップグレード を参照すること。

手順

削除する

Podの名前を見つけます。Kafka ブローカー Pod の名前は <cluster-name>-kafka-<index> です。ここで、<index> はゼロで始まり、レプリカの合計数から 1 を引いた数で終了します。例:

my-cluster-kafka-0OpenShift で

Podリソースにアノテーションを付けます。oc annotateを使用します。oc annotate pod cluster-name-kafka-index strimzi.io/delete-pod-and-pvc=true- 基盤となる永続ボリューム要求 (Persistent Volume Claim) でアノテーションが付けられた Pod が削除され、再作成されるときに、次の調整の実行を待ちます。

2.2.8. ZooKeeper ノードの手動による削除

この手順では、OpenShift アノテーションを使用して既存の ZooKeeper ノードを削除する方法を説明します。ZooKeeper ノードを削除するには、ZooKeeper が稼働している Pod と、関連する PersistentVolumeClaim の両方を削除します (クラスターが永続ストレージでデプロイされた場合)。削除後、Pod と関連する PersistentVolumeClaim が自動的に再作成されます。

PersistentVolumeClaim を削除すると、データが永久に失われる可能性があります。以下の手順は、ストレージで問題が発生した場合にのみ実行してください。

前提条件

以下を実行する方法については、OpenShift での AMQ Streams のデプロイおよびアップグレード を参照すること。

手順

削除する

Podの名前を見つけます。ZooKeeper Pod の名前は <cluster-name>-zookeeper-<index> です。ここで、<index> はゼロで始まり、レプリカの合計数から 1 を引いた数で終了します。例:

my-cluster-zookeeper-0OpenShift で

Podリソースにアノテーションを付けます。oc annotateを使用します。oc annotate pod cluster-name-zookeeper-index strimzi.io/delete-pod-and-pvc=true- 基盤となる永続ボリューム要求 (Persistent Volume Claim) でアノテーションが付けられた Pod が削除され、再作成されるときに、次の調整の実行を待ちます。

2.2.9. Kafka クラスターリソースのリスト

以下のリソースは、OpenShift クラスターの Cluster Operator によって作成されます。

共有リソース

cluster-name-cluster-ca- クラスター通信の暗号化に使用されるクラスター CA プライベートキーのあるシークレット。

cluster-name-cluster-ca-cert- クラスター CA 公開鍵のあるシークレット。このキーは、Kafka ブローカーのアイデンティティーの検証に使用できます。

cluster-name-clients-ca- ユーザー証明書に署名するために使用されるクライアント CA 秘密鍵のあるシークレット。

cluster-name-clients-ca-cert- クライアント CA 公開鍵のあるシークレット。このキーは、Kafka ユーザーのアイデンティティーの検証に使用できます。

cluster-name-cluster-operator-certs- Kafka および ZooKeeper と通信するための Cluster Operator キーのあるシークレット。

ZooKeeper ノード

cluster-name-zookeeper以下の ZooKeeper リソースに指定された名前。

- ZooKeeper ノード Pod を管理する StatefulSet または StrimziPodSet (UseStrimziPodSets フィーチャーゲート が有効になっている場合)。

- ZooKeeper ノードで使用されるサービスアカウント。

- ZooKeeper ノードに設定された PodDisruptionBudget。

cluster-name-zookeeper-idx- ZooKeeper StatefulSet または StrimziPodSet によって作成された Pod。

cluster-name-zookeeper-nodes- DNS が ZooKeeper Pod の IP アドレスを直接解決するのに必要なヘッドレスサービス。

cluster-name-zookeeper-client- Kafka ブローカーがクライアントとして ZooKeeper ノードに接続するために使用するサービス。

cluster-name-zookeeper-config- ZooKeeper 補助設定が含まれ、ZooKeeper ノード Pod によってボリュームとしてマウントされる ConfigMap。

cluster-name-zookeeper-nodes- ZooKeeper ノードキーがあるシークレット。

cluster-name-network-policy-zookeeper- ZooKeeper サービスへのアクセスを管理するネットワークポリシー。

data-cluster-name-zookeeper-idx-

ZooKeeper ノード Pod

idxのデータを保存するために使用されるボリュームの永続ボリューム要求です。このリソースは、データを保存するために永続ボリュームのプロビジョニングに永続ストレージが選択された場合のみ作成されます。

Kafka ブローカー

cluster-name-kafka以下の Kafka リソースに指定された名前。

- Kafka ブローカー Pod を管理する StatefulSet または StrimziPodSet (UseStrimziPodSets フィーチャーゲート が有効になっている場合)。

- Kafka Pod によって使用されるサービスアカウント。

- Kafka ブローカーに設定された PodDisruptionBudget。

cluster-name-kafka-idx以下の Kafka リソースに指定された名前。

- Kafka StatefulSet または StrimziPodSet によって作成された Pod。

- Kafka ブローカー設定を使用した ConfigMap (UseSrimziPodSets 機能ゲート が有効になっている場合)。

cluster-name-kafka-brokers- DNS が Kafka ブローカー Pod の IP アドレスを直接解決するのに必要なサービス。

cluster-name-kafka-bootstrap- サービスは、OpenShift クラスター内から接続する Kafka クライアントのブートストラップサーバーとして使用できます。

cluster-name-kafka-external-bootstrap-

OpenShift クラスター外部から接続するクライアントのブートストラップサービス。このリソースは、外部リスナーが有効な場合にのみ作成されます。リスナー名が

externalでポートが9094の場合、後方互換性のために古いサービス名が使用されます。 cluster-name-kafka-pod-id-

トラフィックを OpenShift クラスターの外部から個別の Pod にルーティングするために使用されるサービス。このリソースは、外部リスナーが有効な場合にのみ作成されます。リスナー名が

externalでポートが9094の場合、後方互換性のために古いサービス名が使用されます。 cluster-name-kafka-external-bootstrap-

OpenShift クラスターの外部から接続するクライアントのブートストラップルート。このリソースは、外部リスナーが有効でタイプが

routeに設定されている場合にのみ作成されます。リスナー名がexternalでポートが9094の場合、後方互換性のために古いルート名が使用されます。 cluster-name-kafka-pod-id-

OpenShift クラスターの外部から個別の Pod へのトラフィックに対するルート。このリソースは、外部リスナーが有効でタイプが

routeに設定されている場合にのみ作成されます。リスナー名がexternalでポートが9094の場合、後方互換性のために古いルート名が使用されます。 cluster-name-kafka-listener-name-bootstrap- OpenShift クラスター外部から接続するクライアントのブートストラップサービス。このリソースは、外部リスナーが有効な場合にのみ作成されます。新しいサービス名はその他すべての外部リスナーに使用されます。

cluster-name-kafka-listener-name-pod-id- トラフィックを OpenShift クラスターの外部から個別の Pod にルーティングするために使用されるサービス。このリソースは、外部リスナーが有効な場合にのみ作成されます。新しいサービス名はその他すべての外部リスナーに使用されます。

cluster-name-kafka-listener-name-bootstrap-

OpenShift クラスターの外部から接続するクライアントのブートストラップルート。このリソースは、外部リスナーが有効でタイプが

routeに設定されている場合にのみ作成されます。新しいルート名はその他すべての外部リスナーに使用されます。 cluster-name-kafka-listener-name-pod-id-

OpenShift クラスターの外部から個別の Pod へのトラフィックに対するルート。このリソースは、外部リスナーが有効でタイプが

routeに設定されている場合にのみ作成されます。新しいルート名はその他すべての外部リスナーに使用されます。 cluster-name-kafka-config- Kafka 補助設定が含まれ、Kafka ブローカー Pod によってボリュームとしてマウントされる ConfigMap。

cluster-name-kafka-brokers- Kafka ブローカーキーのあるシークレット。

cluster-name-network-policy-kafka- Kafka サービスへのアクセスを管理するネットワークポリシー。

strimzi-namespace-name-cluster-name-kafka-init- Kafka ブローカーによって使用されるクラスターロールバインディング。

cluster-name-jmx- Kafka ブローカーポートのセキュア化に使用される JMX ユーザー名およびパスワードのあるシークレット。このリソースは、Kafka で JMX が有効になっている場合にのみ作成されます。

data-cluster-name-kafka-idx-

Kafka ブローカー Pod

idxのデータを保存するために使用されるボリュームの永続ボリューム要求です。このリソースは、データを保存するために永続ボリュームのプロビジョニングに永続ストレージが選択された場合のみ作成されます。 data-id-cluster-name-kafka-idx-

Kafka ブローカー Pod

idxのデータを保存するために使用されるボリュームidの永続ボリューム要求です。このリソースは、永続ボリュームをプロビジョニングしてデータを保存するときに、JBOD ボリュームに永続ストレージが選択された場合のみ作成されます。

Entitiy Operator

これらのリソースは、Cluster Operator を使用して Entity Operator がデプロイされる場合にのみ作成されます。

cluster-name-entity-operator以下の Entity Operator リソースに指定された名前:

- Topic および User Operator とのデプロイメント。

- Entity Operator によって使用されるサービスアカウント。

cluster-name-entity-operator-random-string- Entity Operator デプロイメントによって作成された Pod。

cluster-name-entity-topic-operator-config- Topic Operator の補助設定のある ConfigMap。

cluster-name-entity-user-operator-config- User Operator の補助設定のある ConfigMap。

cluster-name-entity-topic-operator-certs- Kafka および ZooKeeper と通信するための Topic Operator キーのあるシークレット。

cluster-name-entity-user-operator-certs- Kafka および ZooKeeper と通信するための User Operator キーのあるシークレット。

strimzi-cluster-name-entity-topic-operator- Entity Topic Operator によって使用されるロールバインディング。

strimzi-cluster-name-entity-user-operator- Entity User Operator によって使用されるロールバインディング。

Kafka Exporter

これらのリソースは、Cluster Operator を使用して Kafka Exporter がデプロイされる場合にのみ作成されます。

cluster-name-kafka-exporter以下の Kafka Exporter リソースに指定された名前。

- Kafka Exporter でのデプロイメント。

- コンシューマーラグメトリクスの収集に使用されるサービス。

- Kafka Exporter によって使用されるサービスアカウント。

cluster-name-kafka-exporter-random-string- Kafka Exporter デプロイメントによって作成された Pod。

Cruise Control

これらのリソースは、Cluster Operator を使用して Cruise Control がデプロイされた場合のみ作成されます。

cluster-name-cruise-control以下の Cruise Control リソースに指定された名前。

- Cruise Control でのデプロイメント。

- Cruise Control との通信に使用されるサービス。

- Cruise Control によって使用されるサービスアカウント。

cluster-name-cruise-control-random-string- Cruise Control デプロイメントによって作成された Pod。

cluster-name-cruise-control-config- Cruise Control の補助設定が含まれ、Cruise Control Pod によってボリュームとしてマウントされる ConfigMap。

cluster-name-cruise-control-certs- Kafka および ZooKeeper と通信するための Cruise Control キーのあるシークレット。

cluster-name-network-policy-cruise-control- Cruise Control サービスへのアクセスを管理するネットワークポリシー。

2.3. Kafka Connect クラスターの設定

KafkaConnect リソースを使用して Kafka Connect デプロイメントを設定します。Kafka Connect は、コネクタープラグインを使用して Kafka ブローカーと他のシステムの間でデータをストリーミングする統合ツールです。Kafka Connect は、Kafka と、データベースなどの外部データソースまたはターゲットを統合するためのフレームワークを提供し、コネクターを使用してデータをインポートまたはエクスポートします。コネクターは、必要な接続設定を提供するプラグインです。

「KafkaConnect スキーマ参照」 KafkaConnect リソースの完全なスキーマについて説明します。

コネクタープラグインのデプロイの詳細は コネクタープラグインを使用した Kafka Connect の拡張 を参照してください。

2.3.1. Kafka Connect の設定

Kafka Connect を使用して、Kafka クラスターへの外部データ接続を設定します。KafkaConnect リソースのプロパティーを使用して、Kafka Connect デプロイメントを設定します。

KafkaConnector の設定

KafkaConnect リソースを使用すると、Kafka Connect のコネクターインスタンスを OpenShift ネイティブに作成および管理できます。

Kafka Connect 設定では、strimzi.io/use-connector-resources アノテーションを追加して、Kafka Connect クラスターの KafkaConnectors を有効にします。また、build 設定を追加して、データ接続に必要なコネクタープラグインを備えたコンテテナーイメージを AMQ Streams が自動的にビルドするようにすることもできます。Kafka Connect コネクターの外部設定は、externalConfiguration プロパティーで指定します。

コネクターを管理するには、Kafka Connect REST API を使用するか、KafkaConnector カスタムリソースを使用します。KafkaConnector リソースは、リンク先の Kafka Connect クラスターと同じ namespace にデプロイする必要があります。これらの方法を使用してコネクターを作成、再設定、または削除する方法は、コネクターの作成および管理 を参照してください。

コネクター設定は、HTTP リクエストの一部として Kafka Connect に渡され、Kafka 自体に保存されます。ConfigMap およびシークレットは、設定やデータの保存に使用される標準的な OpenShift リソースです。ConfigMap およびシークレットを使用してコネクターの特定の要素を設定できます。その後、HTTP REST コマンドで設定値を参照できます。これにより、必要な場合は設定が分離され、よりセキュアになります。この方法は、ユーザー名、パスワード、証明書などの機密性の高いデータに適用されます。

大量のメッセージ処理

設定を調整して、大量のメッセージを処理できます。詳細は、「大量のメッセージ処理」 を参照してください。

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator

以下を実行する方法については、OpenShift での AMQ Streams のデプロイおよびアップグレード を参照すること。

手順

KafkaConnectリソースのspecプロパティーを編集します。設定可能なプロパティーは以下の例のとおりです。

apiVersion: kafka.strimzi.io/v1beta2 kind: KafkaConnect1 metadata: name: my-connect-cluster annotations: strimzi.io/use-connector-resources: "true"2 spec: replicas: 33 authentication:4 type: tls certificateAndKey: certificate: source.crt key: source.key secretName: my-user-source bootstrapServers: my-cluster-kafka-bootstrap:90925 tls:6 trustedCertificates: - secretName: my-cluster-cluster-cert certificate: ca.crt - secretName: my-cluster-cluster-cert certificate: ca2.crt config:7 group.id: my-connect-cluster offset.storage.topic: my-connect-cluster-offsets config.storage.topic: my-connect-cluster-configs status.storage.topic: my-connect-cluster-status key.converter: org.apache.kafka.connect.json.JsonConverter value.converter: org.apache.kafka.connect.json.JsonConverter key.converter.schemas.enable: true value.converter.schemas.enable: true config.storage.replication.factor: 3 offset.storage.replication.factor: 3 status.storage.replication.factor: 3 build:8 output:9 type: docker image: my-registry.io/my-org/my-connect-cluster:latest pushSecret: my-registry-credentials plugins:10 - name: debezium-postgres-connector artifacts: - type: tgz url: https://repo1.maven.org/maven2/io/debezium/debezium-connector-postgres/1.3.1.Final/debezium-connector-postgres-1.3.1.Final-plugin.tar.gz sha512sum: 962a12151bdf9a5a30627eebac739955a4fd95a08d373b86bdcea2b4d0c27dd6e1edd5cb548045e115e33a9e69b1b2a352bee24df035a0447cb820077af00c03 - name: camel-telegram artifacts: - type: tgz url: https://repo.maven.apache.org/maven2/org/apache/camel/kafkaconnector/camel-telegram-kafka-connector/0.7.0/camel-telegram-kafka-connector-0.7.0-package.tar.gz sha512sum: a9b1ac63e3284bea7836d7d24d84208c49cdf5600070e6bd1535de654f6920b74ad950d51733e8020bf4187870699819f54ef5859c7846ee4081507f48873479 externalConfiguration:11 env: - name: AWS_ACCESS_KEY_ID valueFrom: secretKeyRef: name: aws-creds key: awsAccessKey - name: AWS_SECRET_ACCESS_KEY valueFrom: secretKeyRef: name: aws-creds key: awsSecretAccessKey resources:12 requests: cpu: "1" memory: 2Gi limits: cpu: "2" memory: 2Gi logging:13 type: inline loggers: log4j.rootLogger: "INFO" readinessProbe:14 initialDelaySeconds: 15 timeoutSeconds: 5 livenessProbe: initialDelaySeconds: 15 timeoutSeconds: 5 metricsConfig:15 type: jmxPrometheusExporter valueFrom: configMapKeyRef: name: my-config-map key: my-key jvmOptions:16 "-Xmx": "1g" "-Xms": "1g" image: my-org/my-image:latest17 rack: topologyKey: topology.kubernetes.io/zone18 template:19 pod: affinity: podAntiAffinity: requiredDuringSchedulingIgnoredDuringExecution: - labelSelector: matchExpressions: - key: application operator: In values: - postgresql - mongodb topologyKey: "kubernetes.io/hostname" connectContainer:20 env: - name: JAEGER_SERVICE_NAME value: my-jaeger-service - name: JAEGER_AGENT_HOST value: jaeger-agent-name - name: JAEGER_AGENT_PORT value: "6831"- 1

KafkaConnectを使用します。- 2

- Kafka Connect クラスターの KafkaConnectors を有効にします。

- 3

- タスクを実行するワーカーの レプリカノード数。

- 4

- mTLS、トークンベースの OAuth、SASL ベース SCRAM-SHA-256/SCRAM-SHA-512、または PLAIN として指定された Kafka Connect クラスターの認証。デフォルトでは、Kafka Connect はプレーンテキスト接続を使用して Kafka ブローカーに接続します。

- 5

- Kafka Connect クラスターに接続するための ブートストラップサーバー。

- 6

- クラスターの TLS 証明書が X.509 形式で保存されるキー名のある TLS による暗号化。複数の証明書が同じシークレットに保存されている場合は、複数回リストできます。

- 7

- ワーカーの Kafka Connect 設定 (コネクターではない)。標準の Apache Kafka 設定が提供されることがありますが、AMQ Streams によって直接管理されないプロパティーに限定されます。

- 8

- コネクタープラグインで自動的にコンテナーイメージをビルドするための ビルド設定プロパティー。

- 9

- (必須) 新しいイメージがプッシュされるコンテナーレジストリーの設定。

- 10

- (必須) 新しいコンテナーイメージに追加するコネクタープラグインとそれらのアーティファクトの一覧。各プラグインは、1 つ以上の

artifactで設定する必要があります。 - 11

- 12

- 13

- 指定された Kafka loggers and log levels が ConfigMap を介して直接的に (

inline) または間接的に (external) に追加されます。カスタム ConfigMap は、log4j.propertiesまたはlog4j2.propertiesキー下に配置する必要があります。Kafka Connectlog4j.rootLoggerロガーでは、ログレベルを INFO、ERROR、WARN、TRACE、DEBUG、FATAL または OFF に設定できます。 - 14

- コンテナーを再起動するタイミング (liveness) およびコンテナーがトラフィックを許可できるタイミング (readiness) を把握するための ヘルスチェック。

- 15

- Prometheus メトリクス。この例では、Prometheus JMX エクスポーターの設定が含まれる ConfigMap を参照して有効になります。

metricsConfig.valueFrom.configMapKeyRef.key配下に空のファイルが含まれる ConfigMap の参照を使用して、追加設定なしでメトリクスを有効にできます。 - 16

- Kafka Connect を実行している仮想マシン (VM) のパフォーマンスを最適化するための JVM 設定オプション。

- 17

- 高度な任意設定: 特別な場合のみ推奨される コンテナーイメージの設定。

- 18

- 特別なオプション: 展開のための Rack awareness 設定。これは、リージョン間ではなく、同じロケーション内でのデプロイメントを目的とした特殊なオプションです。このオプションは、コネクターがリーダーレプリカではなく、最も近いレプリカから消費する場合に使用できます。場合によっては、最も近いレプリカから消費することで、ネットワークの使用率を改善したり、コストを削減したりできます。

topologyKeyは、ラック ID を含むノードラベルと一致する必要があります。この設定で使用される例では、標準のtopology.kubernetes.io/zoneラベルを使用するゾーンを指定します。最も近いレプリカから消費するには、Kafka ブローカー設定でRackAwareReplicaSelectorを有効にします。 - 19

- テンプレートのカスタマイズ。ここでは、Pod は非アフィニティーでスケジュールされるため、Pod は同じホスト名のノードではスケジュールされません。

- 20

- 分散トレース用に環境変数が設定されます。

リソースを作成または更新します。

oc apply -f KAFKA-CONNECT-CONFIG-FILE- Kafka Connect の承認が有効である場合、Kafka Connect ユーザーを設定し、Kafka Connect のコンシューマーグループおよびトピックへのアクセスを有効化 します。

2.3.2. 複数インスタンスの Kafka Connect 設定

Kafka Connect のインスタンスを複数実行している場合は、以下の config プロパティーのデフォルト設定を変更する必要があります。

apiVersion: kafka.strimzi.io/v1beta2

kind: KafkaConnect

metadata:

name: my-connect

spec:

# ...

config:

group.id: connect-cluster

offset.storage.topic: connect-cluster-offsets

config.storage.topic: connect-cluster-configs

status.storage.topic: connect-cluster-status

# ...

# ...

group.id が同じすべての Kafka Connect インスタンスで、これら 3 つのトピックの値を揃える必要があります。

デフォルト設定を変更しないと、同じ Kafka クラスターに接続する各 Kafka Connect インスタンスは同じ値でデプロイされます。その結果、事実上はすべてのインスタンスが結合されてクラスターで実行され、同じトピックが使用されます。

複数の Kafka Connect クラスターが同じトピックの使用を試みると、Kafka Connect は想定どおりに動作せず、エラーが生成されます。

複数の Kafka Connect インスタンスを実行する場合は、インスタンスごとにこれらのプロパティーの値を変更してください。

2.3.3. Kafka Connect のユーザー承認の設定

この手順では、Kafka Connect のユーザーアクセスを承認する方法を説明します。

Kafka でいずれかのタイプの承認が使用される場合、Kafka Connect ユーザーは Kafka Connect のコンシューマーグループおよび内部トピックへの読み書きアクセス権限が必要になります。

コンシューマーグループおよび内部トピックのプロパティーは AMQ Streams によって自動設定されますが、KafkaConnect リソースの spec で明示的に指定することもできます。

KafkaConnect リソースの設定プロパティーの例

apiVersion: kafka.strimzi.io/v1beta2

kind: KafkaConnect

metadata:

name: my-connect

spec:

# ...

config:

group.id: my-connect-cluster

offset.storage.topic: my-connect-cluster-offsets

config.storage.topic: my-connect-cluster-configs

status.storage.topic: my-connect-cluster-status

# ...

# ...

この手順では、simple 承認の使用時にアクセス権限が付与される方法を説明します。

簡易承認では、Kafka AclAuthorizer プラグインによって処理される ACL ルールを使用し、適切なレベルのアクセス権限が提供されます。KafkaUser リソースに簡易認証を使用するように設定する方法については、AclRule スキーマリファレンスを参照してください。

複数のインスタンスを実行 している場合、コンシューマーグループとトピックのデフォルト値は異なります。

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator

手順

KafkaUserリソースのauthorizationプロパティーを編集し、アクセス権限をユーザーに付与します。以下の例では、

literalの名前の値を使用して Kafka Connect トピックおよびコンシューマーグループにアクセス権限が設定されます。Expand プロパティー 名前 offset.storage.topicconnect-cluster-offsetsstatus.storage.topicconnect-cluster-statusconfig.storage.topicconnect-cluster-configsgroupconnect-clusterapiVersion: kafka.strimzi.io/v1beta2 kind: KafkaUser metadata: name: my-user labels: strimzi.io/cluster: my-cluster spec: # ... authorization: type: simple acls: # access to offset.storage.topic - resource: type: topic name: connect-cluster-offsets patternType: literal operations: - Create - Describe - Read - Write host: "*" # access to status.storage.topic - resource: type: topic name: connect-cluster-status patternType: literal operations: - Create - Describe - Read - Write host: "*" # access to config.storage.topic - resource: type: topic name: connect-cluster-configs patternType: literal operations: - Create - Describe - Read - Write host: "*" # consumer group - resource: type: group name: connect-cluster patternType: literal operations: - Read host: "*"リソースを作成または更新します。

oc apply -f KAFKA-USER-CONFIG-FILE

2.3.4. Kafka Connect クラスターリソースの一覧

以下のリソースは、OpenShift クラスターの Cluster Operator によって作成されます。

- connect-cluster-name-connect

- Kafka Connect ワーカーノード Pod の作成を担当するデプロイメント。

- connect-cluster-name-connect-api

- Kafka Connect クラスターを管理するために REST インターフェイスを公開するサービス。

- connect-cluster-name-config

- Kafka Connect 補助設定が含まれ、Kafka ブローカー Pod によってボリュームとしてマウントされる ConfigMap。

- connect-cluster-name-connect

- Kafka Connect ワーカーノードに設定された Pod の Disruption Budget。

2.3.5. 変更データキャプチャーのための Debezium の Red Hat ビルドとの統合

Debezium の Red Hat ビルドは、分散型の変更データキャプチャープラットフォームです。データベースの行レベルの変更をキャプチャーして、変更イベントレコードを作成し、Kafka トピックにレコードをストリーミングします。Debezium は Apache Kafka に構築されます。AMQ Streams で Debezium の Red Hat ビルドをデプロイおよび統合できます。AMQ Streams のデプロイ後に、Kafka Connect で Debezium をコネクター設定としてデプロイします。Debezium は変更イベントレコードを AMQ Streams on OpenShift に渡します。アプリケーションは 変更イベントストリーム を読み取りでき、変更イベントが発生した順にアクセスできます。

Debezium には、以下を含む複数の用途があります。

- データレプリケーション

- キャッシュの更新およびインデックスの検索

- モノリシックアプリケーションの簡素化

- データ統合

- ストリーミングクエリーの有効化

データベースの変更をキャプチャーするには、Debezium データベースコネクターで Kafka Connect をデプロイします。KafkaConnector リソースを設定し、コネクターインスタンスを定義します。

AMQ Streams で Debezium の Red Hat ビルドをデプロイする方法の詳細は、製品ドキュメント を参照してください。ドキュメントには、Debezium スタートガイド が含まれています。このガイドでは、データベース更新の変更イベントレコードの表示に必要なサービスおよびコネクターの設定方法を説明しています。

2.4. Kafka MirrorMaker 2.0 クラスターの設定

KafkaMirrorMaker2 リソースを使用して Kafka MirrorMaker 2.0 デプロイメントを設定します。MirrorMaker 2.0 は、データセンター内またはデータセンター間で、2 つ以上の Kafka クラスター間でデータを複製します。

「KafkaMirrorMaker2 スキーマ参照」 KafkaMirrorMaker2 リソースの完全なスキーマについて説明します。

MirrorMaker 2.0 リソース設定は、以前のバージョンの MirrorMaker とは異なります。MirrorMaker 2.0 の使用を選択した場合、現在、レガシーサポートがないため、リソースを手作業で新しい形式に変換する必要があります。

2.4.1. MirrorMaker 2.0 データレプリケーション

クラスター全体のデータレプリケーションでは、以下が必要な状況がサポートされます。

- システム障害時のデータの復旧

- 分析用のデータの集計

- 特定のクラスターへのデータアクセスの制限

- レイテンシーを改善するための特定場所でのデータのプロビジョニング

2.4.1.1. MirrorMaker 2.0 の設定

MirrorMaker 2.0 はソースの Kafka クラスターからメッセージを消費して、ターゲットの Kafka クラスターに書き込みます。

MirrorMaker 2.0 は以下を使用します。

- ソースクラスターからデータを消費するソースクラスターの設定

- データをターゲットクラスターに出力するターゲットクラスターの設定

MirrorMaker 2.0 は Kafka Connect フレームワークをベースとし、コネクター によってクラスター間のデータ転送が管理されます。

MirrorMaker 2.0 を設定して、ソースクラスターとターゲットクラスターの接続の詳細を含む Kafka Connect のデプロイメントを定義し、MirrorMaker 2.0 コネクターのセットを実行して接続を確立します。

MirrorMaker 2.0 は、以下のコネクターで設定されます。

MirrorSourceConnector-

ソースコネクターは、トピックをソースクラスターからターゲットクラスターに複製します。また、ACL をレプリケートし、

MirrorCheckpointConnectorを実行する必要があります。 MirrorCheckpointConnector- チェックポイントコネクターは定期的にオフセットを追跡します。有効にすると、ソースクラスターとターゲットクラスター間のコンシューマーグループオフセットも同期されます。

MirrorHeartbeatConnector- ハートビートコネクターは、ソースクラスターとターゲットクラスター間の接続を定期的にチェックします。

User Operator を使用して ACL を管理する場合、コネクターを介した ACL レプリケーションはできません。

ソースクラスターからターゲットクラスターへのデータの ミラーリング プロセスは非同期です。各 MirrorMaker 2.0 インスタンスは、1 つのソースクラスターから 1 つのターゲットクラスターにデータをミラーリングします。複数の MirrorMaker 2.0 インスタンスを使用して、任意の数のクラスター間でデータをミラーリングできます。

図2.1 2 つのクラスターにおけるレプリケーション

デフォルトでは、ソースクラスターの新規トピックのチェックは 10 分ごとに行われます。頻度は、refresh.topics.interval.seconds をソースコネクター設定に追加することで変更できます。

2.4.1.1.1. クラスター設定

active/passive または active/active クラスター設定で MirrorMaker 2.0 を使用できます。

- アクティブ/アクティブのクラスター設定

- アクティブ/アクティブ設定には、双方向でデータを複製するアクティブなクラスターが 2 つあります。アプリケーションはいずれかのクラスターを使用できます。各クラスターは同じデータを提供できます。これにより、地理的に異なる場所で同じデータを利用できるようにします。コンシューマーグループは両方のクラスターでアクティブであるため、レプリケートされたトピックのコンシューマーオフセットはソースクラスターに同期されません。

- アクティブ/パッシブクラスター設定

- アクティブ/パッシブ設定には、パッシブクラスターにデータをレプリケートするアクティブクラスターがあります。パッシブクラスターはスタンバイのままになります。システムに障害が発生した場合に、データ復旧にパッシブクラスターを使用できます。

プロデューサーとコンシューマーがアクティブなクラスターのみに接続することを前提とします。MirrorMaker 2.0 クラスターは、ターゲットの宛先ごとに必要です。

2.4.1.1.2. 双方向レプリケーション (active/active)

MirrorMaker 2.0 アーキテクチャーでは、active/active クラスター設定で双方向レプリケーションがサポートされます。

各クラスターは、source および remote トピックの概念を使用して、別のクラスターのデータを複製します。同じトピックが各クラスターに保存されるため、リモートトピックの名前がソースクラスターを表すように自動的に MirrorMaker 2.0 によって変更されます。元のクラスターの名前の先頭には、トピックの名前が追加されます。

図2.2 トピック名の変更

ソースクラスターにフラグを付けると、トピックはそのクラスターに複製されません。

remote トピックを介したレプリケーションの概念は、データの集約が必要なアーキテクチャーの設定に役立ちます。コンシューマーは、同じクラスター内でソースおよびリモートトピックにサブスクライブできます。これに個別の集約クラスターは必要ありません。

2.4.1.1.3. 一方向レプリケーション (active/passive)

MirrorMaker 2.0 アーキテクチャーでは、active/passive クラスター設定でー方向レプリケーションがサポートされます。

active/passive のクラスター設定を使用してバックアップを作成したり、データを別のクラスターに移行したりできます。この場合、リモートトピックの名前を自動的に変更したくないことがあります。

IdentityReplicationPolicy をソースコネクター設定に追加することで、名前の自動変更をオーバーライドできます。この設定が適用されると、トピックには元の名前が保持されます。

2.4.1.2. トピック設定の同期

MirrorMaker 2.0 は、ソースクラスターとターゲットクラスター間のトピック設定の Synchronization をサポートしています。MirrorMaker 2.0 設定でソーストピックを指定します。MirrorMaker 2.0 は、ソーストピックを監視します。MirrorMaker 2.0 は、ソーストピックへの変更を検出してリモートトピックに伝播します。変更には、欠けているトピックおよびパーティションの自動作成が含まれる場合があります。

ほとんどの場合、ローカルトピックに書き込み、リモートトピックから読み取ります。リモートトピックでは書き込み操作ができないわけではありませんが、使用しないようにしてください。

2.4.1.3. オフセットの追跡

MirrorMaker 2.0 では、内部トピックを使用してコンシューマーグループのオフセットを追跡します。

offset-syncsトピック-

offset-syncsトピックは、複製されたトピックパーティションのソースおよびターゲットオフセットをレコードメタデータからマッピングします。 checkpointsトピック-

checkpointsトピックは、各コンシューマーグループで複製されたトピックパーティションのソースおよびターゲットクラスターで、最後にコミットされたオフセットをマッピングします。

MirrorMaker 2.0 によって内部で使用されるため、これらのトピックと直接対話することはありません。

MirrorCheckpointConnector は、オフセット追跡用の チェックポイント を発行します。チェックポイント トピックのオフセットは、設定によって事前に決定された間隔で追跡されます。両方のトピックは、フェイルオーバー時に正しいオフセットの位置からレプリケーションの完全復元を可能にします。

offset-syncs トピックの場所は、デフォルトで source クラスターです。offset-syncs.topic.location コネクター設定を使用して、これを target クラスターに変更することができます。トピックが含まれるクラスターへの読み取り/書き込みアクセスが必要です。ターゲットクラスターを offset-syncs トピックの場所として使用すると、ソースクラスターへの読み取りアクセスしかない場合でも、MirrorMaker 2.0 を使用できます。

2.4.1.4. コンシューマーグループオフセットの同期

__consumer_offsets トピックには、各コンシューマーグループのコミットされたオフセットに関する情報が保存されます。オフセットの同期は、ソースクラスターのコンシューマーグループのコンシューマーオフセットをターゲットクラスターのコンシューマーオフセットに定期的に転送します。

オフセットの同期は、特に active/passive 設定で便利です。アクティブなクラスターがダウンした場合、コンシューマーアプリケーションはパッシブ (スタンバイ) クラスターに切り替え、最後に転送されたオフセットの位置からピックアップできます。

トピックオフセットの同期を使用するには、sync.group.offsets.enabled を checkpoint コネクター設定に追加し、プロパティーを true に設定して、同期を有効にします。同期はデフォルトで無効になっています。

ソースコネクターで IdentityReplicationPolicy を使用する場合は、チェックポイントコネクター設定でも設定する必要があります。これにより、ミラーリングされたコンシューマーオフセットが正しいトピックに適用されます。

コンシューマーオフセットは、ターゲットクラスターでアクティブではないコンシューマーグループに対してのみ同期されます。コンシューマーグループがターゲットクラスターにある場合、Synchronization を実行できず、UNKNOWN_MEMBER_ID エラーが返されます。

同期を有効にすると、ソースクラスターからオフセットの同期が定期的に行われます。この頻度は、sync.group.offsets.interval.seconds および emit.checkpoints.interval.seconds をチェックポイントコネクター設定に追加することで変更できます。これらのプロパティーは、コンシューマーグループのオフセットが同期される頻度 (秒単位) と、オフセットを追跡するためにチェックポイントが生成される頻度を指定します。両方のプロパティーのデフォルトは 60 秒です。refresh.groups.interval.seconds プロパティーを使用して、新規コンシューマーグループのチェック頻度を変更することもできます。デフォルトでは 10 分ごとに実行されます。

同期は時間ベースであるため、コンシューマーによってパッシブクラスターへ切り替えられると、一部のメッセージが重複する可能性があります。

Java で作成されたアプリケーションがある場合は、RemoteClusterUtils.java ユーティリティーを使用して、アプリケーションを通じてオフセットを同期できます。ユーティリティーは、checkpoints トピックからコンシューマーグループのリモートオフセットを取得します。

2.4.1.5. 接続性チェック

MirrorHeartbeatConnector は heartbeat を発行して、クラスター間の接続を確認します。

内部 heartbeat トピックは、ソースクラスターからレプリケートされます。ターゲットクラスターは、heartbeat トピックを使用して次のことを確認します。

- クラスター間の接続を管理するコネクターが稼働しているかどうか

- ソースクラスターが利用可能かどうか

2.4.2. コネクター設定

Kafka クラスター間のデータの同期を調整する内部コネクターの Mirrormaker 2.0 コネクター設定を使用します。

以下の表は、コネクタープロパティーと、これらを使用するために設定するコネクターについて説明しています。

| プロパティー | sourceConnector | checkpointConnector | heartbeatConnector |

|---|---|---|---|

| ✓ | ✓ | ✓ |

| ✓ | ✓ | ✓ |

| ✓ | ✓ | ✓ |

| ✓ | ✓ | |

| ✓ | ✓ | |

| ✓ | ✓ | |

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ | ||

| ✓ |

2.4.3. コネクタープロデューサーおよびコンシューマーの設定

MirrorMaker 2.0 コネクターは内部プロデューサーおよびコンシューマーを使用します。必要に応じて、これらのプロデューサーおよびコンシューマーを設定して、デフォルト設定を上書きできます。

たとえば、トピックをターゲットの Kafka クラスターに送信するソースプロデューサーの batch.size を増やして、大量のデータをより適切に対応できます。

プロデューサーとコンシューマーの設定オプションは、MirrorMaker 2.0 の実装に依存し、変更される可能性があります。

次の表では、各コネクターのプロデューサーとコンシューマー、および設定を追加できる場所について説明します。

| タイプ | 説明 | 設定 |

|---|---|---|

| プロデューサー | トピックメッセージをターゲット Kafka クラスターに送信します。大量のデータを処理する場合は、このプロデューサーの設定を調整することを検討してください。 |

|

| プロデューサー |

レプリケートされたトピックパーティションのソースオフセットとターゲットオフセットをマップする、 |

|

| コンシューマー | ソース Kafka クラスターからトピックメッセージを取得します。 |

|

| タイプ | 説明 | 設定 |

|---|---|---|

| プロデューサー | コンシューマーオフセットチェックポイントを発行します。 |

|

| コンシューマー |

|

|

offset-syncs.topic.location を target に設定して、ターゲット Kafka クラスターを offset-syncs トピックの場所として使用できます。

| タイプ | 説明 | 設定 |

|---|---|---|

| プロデューサー | ハートビートを生成します。 |

|

次の例は、プロデューサーとコンシューマーを設定する方法を示しています。

コネクターのプロデューサーとコンシューマーの設定例

apiVersion: kafka.strimzi.io/v1beta2

kind: KafkaMirrorMaker2

metadata:

name: my-mirror-maker2

spec:

version: 3.3.1

# ...

mirrors:

- sourceCluster: "my-cluster-source"

targetCluster: "my-cluster-target"

sourceConnector:

tasksMax: 5

config:

producer.override.batch.size: 327680

producer.override.linger.ms: 100

producer.request.timeout.ms: 30000

consumer.fetch.max.bytes: 52428800

# ...

checkpointConnector:

config:

producer.override.request.timeout.ms: 30000

consumer.max.poll.interval.ms: 300000

# ...

heartbeatConnector:

config:

producer.override.request.timeout.ms: 30000

# ...2.4.4. タスクの最大数を指定

コネクターは、Kafka にデータを出し入れするタスクを作成します。各コネクターは、タスクを実行するワーカー Pod のグループ全体に分散される 1 つ以上のタスクで設定されます。タスクの数を増やすと、多数のパーティションをレプリケートするとき、または多数のコンシューマーグループのオフセットを同期するときのパフォーマンスの問題に役立ちます。

タスクは並行して実行されます。ワーカーには 1 つ以上のタスクが割り当てられます。1 つのタスクが 1 つのワーカー Pod によって処理されるため、タスクよりも多くのワーカー Pod は必要ありません。ワーカーよりも多くのタスクがある場合、ワーカーは複数のタスクを処理します。

tasksMax プロパティーを使用して、MirrorMaker 設定でコネクタータスクの最大数を指定できます。タスクの最大数を指定しない場合、デフォルト設定のタスク数は 1 つです。

ハートビートコネクターは常に単一のタスクを使用します。

ソースおよびチェックポイントコネクターに対して開始されるタスクの数は、可能なタスクの最大数と tasksMax の値の間の低い値です。ソースコネクターの場合、可能なタスクの最大数は、ソースクラスターからレプリケートされるパーティションごとに 1 つです。チェックポイントコネクターの場合、可能なタスクの最大数は、ソースクラスターからレプリケートされるコンシューマーグループごとに 1 つです。タスクの最大数を設定するときは、プロセスをサポートするパーティションの数とハードウェアリソースを考慮してください。

インフラストラクチャーが処理のオーバーヘッドをサポートしている場合、タスクの数を増やすと、スループットと待機時間が向上する可能性があります。たとえば、タスクを追加すると、多数のパーティションまたはコンシューマーグループがある場合に、ソースクラスターのポーリングにかかる時間が短縮されます。

チェックポイントコネクターのタスク数を増やすと、多数のパーティションがある場合に役立ちます。

ソースコネクターのタスク数を増やす

apiVersion: kafka.strimzi.io/v1beta2

kind: KafkaMirrorMaker2

metadata:

name: my-mirror-maker2

spec:

# ...

mirrors:

- sourceCluster: "my-cluster-source"

targetCluster: "my-cluster-target"

sourceConnector:

tasksMax: 10

# ...多数のコンシューマーグループがある場合は、チェックポイントコネクターのタスク数を増やすと便利です。

チェックポイントコネクターのタスク数の増加

apiVersion: kafka.strimzi.io/v1beta2

kind: KafkaMirrorMaker2

metadata:

name: my-mirror-maker2

spec:

# ...

mirrors:

- sourceCluster: "my-cluster-source"

targetCluster: "my-cluster-target"

checkpointConnector:

tasksMax: 10

# ...

デフォルトでは、MirrorMaker 2.0 は新しいコンシューマーグループを 10 分ごとにチェックします。refresh.groups.interval.seconds 設定を調整して、頻度を変更できます。低く調整するときは注意してください。より頻繁なチェックは、パフォーマンスに悪影響を及ぼす可能性があります。

2.4.4.1. コネクタータスクの動作の確認

Prometheus と Grafana を使用して展開を監視している場合は、MirrorMaker 2.0 のパフォーマンスを確認できます。AMQ Streams で提供される MirrorMaker 2.0 Grafana ダッシュボードの例には、タスクとレイテンシーに関連する次のメトリックが表示されます。

- タスクの数

- レプリケーションのレイテンシー

- オフセット同期のレイテンシー

2.4.5. ACL ルールの同期

User Operator を使用して いない 場合は、ACL でリモートトピックにアクセスできます。

User Operator なしで AclAuthorizer が使用されている場合、ブローカーへのアクセスを管理する ACL ルールはリモートトピックにも適用されます。ソーストピックを読み取りできるユーザーは、そのリモートトピックを読み取りできます。

OAuth 2.0 での承認は、このようなリモートトピックへのアクセスをサポートしません。

2.4.6. Kafka MirrorMaker 2.0 の設定

KafkaMirrorMaker2 リソースのプロパティーを使用して、Kafka MirrorMaker 2.0 のデプロイメントを設定します。MirrorMaker 2.0 を使用して、Kafka クラスター間のデータを同期します。

設定では以下を指定する必要があります。

- 各 Kafka クラスター

- 認証を含む各クラスターの接続情報

レプリケーションのフローおよび方向

- クラスター対クラスター

- トピック対トピック

従来のバージョンの MirrorMaker は継続してサポートされます。従来のバージョンに設定したリソースを使用する場合は、MirrorMaker 2.0 でサポートされる形式に更新する必要があります。

MirrorMaker 2.0 によって、レプリケーション係数などのプロパティーのデフォルト設定値が提供されます。デフォルトに変更がない最小設定の例は以下のようになります。

MirrorMaker 2.0 の最小設定

apiVersion: kafka.strimzi.io/v1beta2

kind: KafkaMirrorMaker2

metadata:

name: my-mirror-maker2

spec:

version: 3.3.1

connectCluster: "my-cluster-target"

clusters:

- alias: "my-cluster-source"

bootstrapServers: my-cluster-source-kafka-bootstrap:9092

- alias: "my-cluster-target"

bootstrapServers: my-cluster-target-kafka-bootstrap:9092

mirrors:

- sourceCluster: "my-cluster-source"

targetCluster: "my-cluster-target"

sourceConnector: {}mTLS または SASL 認証を使用して、ソースおよびターゲットクラスターのアクセス制御を設定できます。この手順では、ソースおよびターゲットクラスターに対して mTLS による暗号化および認証を使用する設定を説明します。

KafkaMirrorMaker2 リソースのソースクラスターからレプリケートするトピックとコンシューマーグループを指定できます。これを行うには、topicsPattern および groupsPattern プロパティーを使用します。名前の一覧を指定したり、正規表現を使用したりできます。既定では、topicsPattern および groupsPattern プロパティーを設定しない場合、すべてのトピックとコンシューマーグループがレプリケートされます。.* を正規表現として使用して、すべてのトピックとコンシューマーグループを複製することもできます。ただし、クラスターに不要な負荷が余分にかかるのを避けるため、必要なトピックとコンシューマーグループのみを指定するようにしてください。

大量のメッセージ処理

設定を調整して、大量のメッセージを処理できます。詳細は、「大量のメッセージ処理」 を参照してください。

前提条件

- AMQ Streams が実行されている

- ソースおよびターゲットの Kafka クラスターが使用できる

手順

KafkaMirrorMaker2リソースのspecプロパティーを編集します。設定可能なプロパティーは以下の例のとおりです。