가시성

Observability가 클러스터의 상태 및 사용률과 전체 워크로드에 대한 통찰력을 제공하는 방법을 확인하십시오.

초록

1장. 관찰 기능 서비스

관찰 기능을 사용하면 추가 테스트 및 지원 없이 성능 문제를 식별하고 평가할 수 있습니다. Red Hat Advanced Cluster Management for Kubernetes 관찰 기능 구성 요소는 클러스터의 상태 및 사용률과 플릿의 워크로드를 이해하는 데 사용할 수 있는 서비스입니다. 관찰 기능 서비스를 사용하면 관찰 기능 내에 있는 구성 요소를 자동화하고 관리할 수 있습니다.

관찰 기능 서비스는 오픈 소스 커뮤니티의 기존 및 널리 채택된 관찰 툴을 사용합니다. 기본적으로 다중 클러스터 관찰 기능 Operator는 Red Hat Advanced Cluster Management를 설치하는 동안 활성화됩니다. Thanos는 장기 메트릭 스토리지를 위해 허브 클러스터 내에 배포됩니다. observability-endpoint-operator 는 가져온 각 관리 클러스터에 자동으로 배포됩니다. 이 컨트롤러는 Red Hat OpenShift Container Platform Prometheus에서 데이터를 수집하는 메트릭 수집기를 시작한 다음 해당 데이터를 Red Hat Advanced Cluster Management Hub 클러스터로 전송합니다.

관찰 구성 요소에 대한 자세한 내용은 다음 문서를 참조하십시오.

1.1. 관찰 기능 아키텍처

multiclusterhub-operator 는 기본적으로 multicluster-observability-operator Pod를 활성화합니다. multicluster-observability-operator Pod를 구성해야 합니다.

1.1.1. 관찰 기능 오픈 소스 구성 요소

관찰 기능 서비스는 커뮤니티의 오픈 소스 관찰 툴을 사용합니다. 제품 관찰 서비스 이외의 툴에 대한 다음 설명을 확인하십시오.

- Thanos: 여러 Prometheus 인스턴스에서 글로벌 쿼리를 수행하는 데 사용할 수 있는 구성 요소의 툴킷입니다. Prometheus 데이터의 장기 스토리지의 경우 S3 호환 스토리지에 유지합니다. 고가용성 및 확장 가능한 메트릭 시스템을 구성할 수도 있습니다.

- Prometheus: 애플리케이션에서 지표를 수집하고 이러한 지표를 시계열 데이터로 저장하는 데 사용할 수 있는 모니터링 및 경고 툴입니다. 스크랩된 모든 샘플을 로컬에 저장하고, 규칙을 실행하여 기존 데이터의 새 시계열을 집계하고 기록하며 경고를 생성합니다.

- Alertmanager: Prometheus에서 경고를 관리하고 수신하는 툴입니다. 이메일, Slack, PagerDuty와 같은 통합에 경고를 중복, 그룹화 및 라우팅합니다. 특정 경고를 음소거하고 차단하도록 Alertmanager를 구성합니다.

1.1.2. 관찰 기능 아키텍처 다이어그램

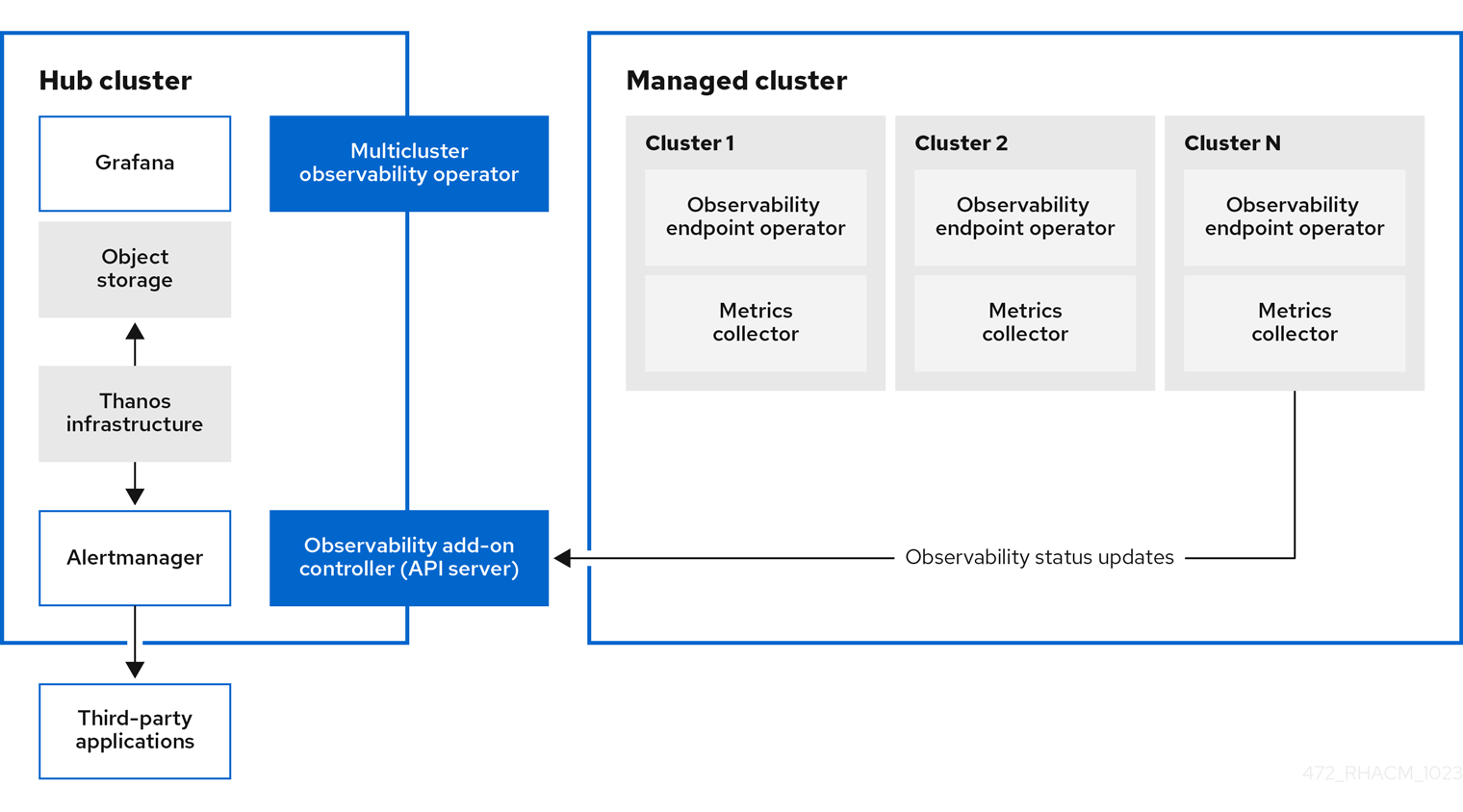

다음 다이어그램은 관찰 가능성의 구성 요소를 보여줍니다.

관찰 기능 아키텍처의 구성 요소에는 다음 항목이 포함됩니다.

-

multiclusterhub-operatorPod라고도 하는 다중 클러스터 허브 Operator는multicluster-observability-operatorPod를 배포합니다.ManifestWorks리소스 생성을 통해 허브 클러스터의 지표 저장소 및 관리되는 클러스터의 수집기와 같이 Red Hat Advanced Cluster Management Observability 서비스에 대한 리소스를 배포하는 루트 구성 요소입니다. - 관찰 기능 애드온 컨트롤러는 관리 클러스터의 로그를 자동으로 업데이트하는 API 서버입니다.

Thanos 인프라에는

multicluster-observability-operatorPod에서 배포한 Thanos Cryostator가 포함되어 있습니다. Thanos Cryostator는 보존 구성을 사용하고 스토리지의 데이터를 압축하여 쿼리가 제대로 수행되도록 합니다.Thanos Cryostator에 문제가 발생할 때 이를 식별하는 데 도움이 되도록 상태를 모니터링하는 4개의 기본 경고를 사용합니다. 다음 기본 경고 테이블을 읽습니다.

Expand 표 1.1. 기본 Thanos 경고 테이블 경고 심각도 설명 ACMThanosCompactHalted심각

compactor가 중지되면 경고가 전송됩니다.

ACMThanosCompactHighCompactionFailures경고

압축 실패 비율이 5%보다 크면 경고가 전송됩니다.

ACMThanosCompactBucketHighOperationFailures경고

버킷 작업 실패 비율이 5%보다 크면 경고가 전송됩니다.

ACMThanosCompactHasNotRun경고

압축기가 지난 24시간 동안 아무것도 업로드하지 않으면 경고가 전송됩니다.

- 관찰 기능 구성 요소는 Grafana 인스턴스를 배포하여 대시보드(static) 또는 데이터 무관을 사용하여 데이터 시각화를 활성화합니다. Red Hat Advanced Cluster Management는 Grafana의 11.1.5 버전을 지원합니다. Grafana 대시보드를 설계할 수도 있습니다. 자세한 내용은 Grafana 대시보드 설계를 참조하십시오.

- Prometheus Alertmanager 를 사용하면 타사 애플리케이션과 함께 경고를 전달할 수 있습니다. 사용자 정의 레코딩 규칙 또는 경고 규칙을 생성하여 관찰 기능 서비스를 사용자 지정할 수 있습니다. Red Hat Advanced Cluster Management는 Prometheus Alertmanager의 버전 0.25를 지원합니다.

1.1.3. observability 서비스에 사용되는 영구 저장소

중요: 영구 스토리지에 로컬 볼륨을 사용하는 로컬 스토리지 Operator 또는 스토리지 클래스를 사용하지 마십시오. 재시작 후 Pod가 다른 노드에서 다시 시작되면 데이터가 손실될 수 있습니다. 이 경우 Pod는 더 이상 노드의 로컬 스토리지에 액세스할 수 없습니다. 데이터 손실을 방지하기 위해 수신 및 규칙 포드의 영구 볼륨에 액세스할 수 있는지 확인합니다.

Red Hat Advanced Cluster Management를 설치할 때 PVC(영구 볼륨 클레임)가 자동으로 연결할 수 있도록 다음과 같은 PV(영구 볼륨)를 생성해야 합니다. 기본 스토리지 클래스가 지정되지 않았거나 기본 스토리지 클래스를 사용하여 PV를 호스팅하려는 경우 MultiClusterObservability 사용자 정의 리소스에 스토리지 클래스를 정의해야 합니다. Prometheus에서 사용하는 것과 유사하게 Block Storage를 사용하는 것이 좋습니다. 또한 alertmanager,thanos-compactor,thanos-ruler,thanos-receive-default 및 thanos-store-shard 의 각 복제본에는 자체 PV가 있어야 합니다. 다음 표를 참조하십시오.

| 구성 요소 이름 | 목적 |

| alertmanager |

Alertmanager는 |

| observability-thanos-compactor | compactor에는 처리를 위한 중간 데이터와 버킷 상태 캐시를 저장하기 위해 로컬 디스크 공간이 필요합니다. 필요한 공간은 기본 블록의 크기에 따라 다릅니다. compactor는 모든 소스 블록을 다운로드할 수 있는 충분한 공간이 있어야 하고 디스크에 압축된 블록을 빌드해야 합니다. 디스크상의 데이터는 재시작 중에 삭제할 수 있으며 크래시 루프 콤팩트러를 가장 먼저 시도해야 합니다. 그러나 다시 시작 사이에 버킷 상태 캐시를 효과적으로 사용하려면 compactor 영구 디스크를 제공하는 것이 좋습니다. |

| observability-thanos-rule |

thanos 룰러는 고정된 간격으로 쿼리를 실행하여 선택한 쿼리 API에 대해 Prometheus 기록 및 경고 규칙을 평가합니다. 규칙 결과는 Prometheus 2.0 스토리지 형식으로 디스크에 다시 작성됩니다. 이 상태 저장 세트에 유지되는 시간 또는 일수의 데이터는 API 버전 |

| observability-thanos-receive-default |

Thanos receiver는 수신 데이터(Prometheus 원격 쓰기 요청)를 수락하고 이를 Prometheus TSDB의 로컬 인스턴스에 씁니다. 주기적으로 (각 2시간), TSDB 블록은 장기 저장 및 압축을 위해 오브젝트 스토리지에 업로드됩니다. 로컬 캐시를 작동하는 이 상태 저장 세트에 유지되는 시간 또는 데이터의 양은 API 버전 |

| observability-thanos-store-shard | 기본적으로 API 게이트웨이 역할을 하므로 상당한 양의 로컬 디스크 공간이 필요하지 않습니다. 시작 시 Thanos 클러스터에 가입하고 액세스할 수 있는 데이터를 알립니다. 로컬 디스크의 모든 원격 블록에 대한 약간의 정보를 유지하고 버킷과 동기화되도록 유지합니다. 이 데이터는 일반적으로 시작 시간이 늘어남에 따라 다시 시작할 때마다 삭제하는 것이 안전합니다. |

참고: 시계열 기록 데이터는 오브젝트 저장소에 저장됩니다. Thanos는 오브젝트 스토리지를 지표 및 메타데이터의 기본 스토리지로 사용합니다. 오브젝트 스토리지 및 다운스ampling에 대한 자세한 내용은 관찰 기능 활성화를 참조하십시오.

1.1.4. 추가 리소스

관찰 기능 및 통합 구성 요소에 대한 자세한 내용은 다음 항목을 참조하십시오.

- Observability 서비스참조

- Observability 구성참조

- 관찰 기능 서비스 활성화를참조하십시오.

- Thanos 설명서 를 참조하십시오.

- Prometheus 개요 를 참조하십시오.

- Alertmanager 설명서 를 참조하십시오.

1.2. 관찰 기능 구성

관찰 기능 서비스가 활성화되면 hub 클러스터는 hub self-management가 활성화되어 있는지 여부와 관계없이 구성된 Thanos 인스턴스에 지표를 수집하고 전송하도록 항상 구성됩니다. 허브 클러스터가 자체 관리되면 disableHubSelfManagement 매개변수가 기본 설정인 false 로 설정됩니다. multiclusterhub-operator 는 기본적으로 multicluster-observability-operator Pod를 활성화합니다. multicluster-observability-operator Pod를 구성해야 합니다.

hub 클러스터에 대한 지표 및 경고가 local-cluster 네임스페이스에 표시됩니다. local-cluster 는 hub self-management가 활성화된 경우에만 사용할 수 있습니다. Grafana Explorer에서 local-cluster 메트릭을 쿼리할 수 있습니다. 관찰 기능 구성 요소를 사용하여 수집할 수 있는 메트릭과 관찰 가능성 Pod 용량에 대한 정보를 계속 읽어 보십시오.

1.2.1. 메트릭 유형

기본적으로 OpenShift Container Platform은 Telemetry 서비스를 사용하여 지표를 Red Hat으로 보냅니다. acm_managed_cluster_info 는 Red Hat Advanced Cluster Management에서 사용할 수 있으며 Telemetry에 포함되어 있지만 Red Hat Advanced Cluster Management Observe 환경 개요 대시보드에는 표시되지 않습니다.

프레임워크에서 지원하는 다음 메트릭 유형을 확인합니다.

| 메트릭 이름 | 메트릭 유형 | 레이블/태그 | 상태 |

|---|---|---|---|

|

| 게이지 |

| 안정적 |

|

| 히스토그램 | 없음 | 안정적입니다. 자세한 내용은 Governance 메트릭 을 참조하십시오. |

|

| 히스토그램 | 없음 | 안정적입니다. 자세한 내용은 Governance 메트릭 을 참조하십시오. |

|

| 히스토그램 | 없음 | 안정적입니다. 자세한 내용은 Governance 메트릭 을 참조하십시오. |

|

| 게이지 |

| 안정적입니다. 자세한 내용은 Governance 메트릭 을 검토하십시오. |

|

| 게이지 |

| 안정적입니다. 자세한 내용은 Managing insight _PolicyReports_ 를 참조하십시오. |

|

| 카운터 | 없음 | 안정적입니다. 콘솔 설명서의 구성 요소 검색 섹션을 참조하십시오. |

|

| 히스토그램 | 없음 | 안정적입니다. 콘솔 설명서의 구성 요소 검색 섹션을 참조하십시오. |

|

| 히스토그램 | 없음 | 안정적입니다. 콘솔 설명서의 구성 요소 검색 섹션을 참조하십시오. |

|

| 카운터 | 없음 | 안정적입니다. 콘솔 설명서의 구성 요소 검색 섹션을 참조하십시오. |

|

| 히스토그램 | 없음 | 안정적입니다. 콘솔 설명서의 구성 요소 검색 섹션을 참조하십시오. |

|

| 게이지 | 없음 | 안정적입니다. 콘솔 설명서의 구성 요소 검색 섹션을 참조하십시오. |

|

| 히스토그램 | 없음 | 안정적입니다. 콘솔 설명서의 구성 요소 검색 섹션을 참조하십시오. |

1.2.2. 기본 메트릭

기본 메트릭을 보려면 다음 명령을 실행하여 observability-metrics-allowlist 를 참조하십시오.

oc -n open-cluster-management-observability get cm observability-metrics-allowlist -o yaml참고: 허용 목록에서 기본 메트릭을 변경할 수 없습니다.

1.2.3. 관찰 기능 Pod 용량 요청

관찰 기능 구성 요소에는 관찰 서비스를 설치하기 위해 Cryostat1mCPU 및 11972Mi 메모리가 필요합니다. 다음 표는 observability-addons 가 활성화된 5개의 관리 클러스터에 대한 Pod 용량 요청 목록입니다.

| Deployment 또는 StatefulSet | 컨테이너 이름 | CPU (mCPU) | 메모리(Mi) | replicas | Pod 총 CPU | Pod 총 메모리 |

|---|---|---|---|---|---|---|

| observability-alertmanager | alertmanager | 4 | 200 | 3 | 12 | 600 |

| config-reloader | 4 | 25 | 3 | 12 | 75 | |

| Alertmanager-proxy | 1 | 20 | 3 | 3 | 60 | |

| observability-grafana | grafana | 4 | 100 | 2 | 8 | 200 |

| grafana-dashboard-loader | 4 | 50 | 2 | 8 | 100 | |

| observability-observatorium-api | observatorium-api | 20 | 128 | 2 | 40 | 256 |

| observability-observatorium-operator | observatorium-operator | 100 | 100 | 1 | 10 | 50 |

| observability-rbac-query-proxy | rbac-query-proxy | 20 | 100 | 2 | 40 | 200 |

| oauth-proxy | 1 | 20 | 2 | 2 | 40 | |

| observability-thanos-compact | Thanos-compact | 500 | 1024 | 1 | 100 | 512 |

| observability-thanos-query | Thanos-query | 300 | 1024 | 2 | 600 | 2048 |

| observability-thanos-query-frontend | Thanos-query-frontend | 100 | 256 | 2 | 200 | 512 |

| observability-thanos-query-frontend-memcached | Memcached | 45 | 128 | 3 | 135 | 384 |

| 내보내기 | 5 | 50 | 3 | 15 | 150 | |

| observability-thanos-receive-controller | Thanos-receive-controller | 4 | 32 | 1 | 4 | 32 |

| observability-thanos-receive-default | Thanos-receive | 300 | 512 | 3 | 900 | 1536 |

| observability-thanos-rule | Thanos-rule | 50 | 512 | 3 | 150 | 1536 |

| configmap-reloader | 4 | 25 | 3 | 12 | 75 | |

| observability-thanos-store-memcached | Memcached | 45 | 128 | 3 | 135 | 384 |

| 내보내기 | 5 | 50 | 3 | 15 | 150 | |

| observability-thanos-store-shard | Thanos-store | 100 | 1024 | 3 | 300 | 3072 |

1.2.4. 추가 리소스

- 관찰 기능 활성화에 대한 자세한 내용은 관찰 기능 서비스 활성화를 참조하십시오.

- 관찰 기능 사용자 지정을 읽고 관찰 기능을 사용자 지정하고 메트릭 및 기타 데이터를 확인하는 방법을 알아봅니다.

- Grafana 대시보드를 사용하여 읽습니다.

- OpenShift Container Platform 설명서에서 Telemetry를 사용하여 수집 및 전송되는 메트릭 유형을 설명합니다. 자세한 내용은 Telemetry에서 수집하는 정보를 참조하십시오.

- 자세한 내용은 Governance 메트릭 을 참조하십시오.

- Prometheus 레코딩 규칙을 참조하십시오.

- Prometheus 경고 규칙 도 참조하십시오.

1.3. Observability 서비스 활성화

허브 클러스터에서 Observability 서비스를 활성화하면 multicluster-observability-operator 는 새 관리 클러스터를 감시하고 관리형 클러스터에 메트릭 및 경고 수집 서비스를 자동으로 배포합니다. 메트릭을 사용하고 Grafana 대시보드를 구성하여 클러스터 리소스 정보를 표시하고 비용을 절감하며 서비스 중단을 방지할 수 있습니다.

multicluster-observability-operator Pod라고도 하는 Observability 구성 요소를 사용하여 관리 클러스터의 상태를 모니터링합니다.

필수 액세스: 클러스터 관리자, open-cluster-management:cluster-manager-admin 역할 또는 S3 관리자.

1.3.1. 사전 요구 사항

- Kubernetes용 Red Hat Advanced Cluster Management를 설치해야 합니다. 자세한 내용은 온라인에 연결된 동안 설치를 참조하십시오.

-

플랫폼 기본

storageClass를 사용하지 않으려면MultiClusterObservability사용자 정의 리소스에서storageConfig.storageClass필드를 지정해야 합니다. - 허브 클러스터에 대한 직접 네트워크 액세스가 필요합니다. 로드 밸런서 및 프록시에 대한 네트워크 액세스는 지원되지 않습니다. 자세한 내용은 네트워킹 을 참조하십시오.

스토리지 솔루션을 생성하려면 오브젝트 저장소를 구성해야 합니다.

- 중요: 오브젝트 저장소를 구성할 때 민감한 데이터가 유지될 때 필요한 암호화 요구 사항을 충족하는지 확인하십시오. Observability 서비스는 Thanos에서 지원되는 안정적인 오브젝트 저장소를 사용합니다. 여러 Red Hat Advanced Cluster Management Observability 설치로 오브젝트 저장소 버킷을 공유하지 못할 수 있습니다. 따라서 각 설치에 대해 별도의 오브젝트 저장소 버킷을 제공합니다.

Red Hat Advanced Cluster Management는 안정적인 오브젝트 저장소를 갖춘 다음과 같은 클라우드 공급자를 지원합니다.

- Amazon Web Services S3 (AWS S3)

- Red Hat Ceph (S3 호환 API)

- Google Cloud Storage

- Azure 스토리지

- Red Hat OpenShift Data Foundation (이전 Red Hat OpenShift Container Storage)

- Red Hat OpenShift on IBM Cloud

1.3.2. 명령줄 인터페이스에서 Observability 활성화

MultiClusterObservability 사용자 정의 리소스 인스턴스를 생성하여 Observability 서비스를 활성화합니다. Observability를 활성화하기 전에 자세한 내용은 Observability Pod 용량 요청을 참조하십시오.

참고:

-

Red Hat Advanced Cluster Management에서 관리하는 OpenShift Container Platform 관리 클러스터에서 Observability가 활성화되거나 비활성화되면 observability 엔드포인트 Operator는 로컬 Prometheus를 자동으로 재시작하는

alertmanager구성을 추가하여cluster-monitoring-config구성 맵을 업데이트합니다. -

Observability 엔드포인트 Operator는 로컬 Prometheus를 자동으로 재시작하는

alertmanager구성을 추가하여cluster-monitoring-config구성 맵을 업데이트합니다. OpenShift Container Platform 관리 클러스터에alertmanager구성을 삽입하면 구성이 Prometheus 메트릭의 retention 필드와 관련된 설정을 제거합니다.

Observability 서비스를 활성화하려면 다음 단계를 완료합니다.

- Red Hat Advanced Cluster Management Hub 클러스터에 로그인합니다.

다음 명령을 사용하여 Observability 서비스의 네임스페이스를 생성합니다.

oc create namespace open-cluster-management-observabilitypull-secret을 생성합니다. Red Hat Advanced Cluster Management가

open-cluster-management네임스페이스에 설치된 경우 다음 명령을 실행합니다.DOCKER_CONFIG_JSON=`oc extract secret/multiclusterhub-operator-pull-secret -n open-cluster-management --to=-`멀티clusterhub-operator-pull-secret이 네임스페이스에 정의되지 않은 경우 다음 명령을 실행하여openshift-config네임스페이스의pull-secret을open-cluster-management-observability네임스페이스로 복사합니다.DOCKER_CONFIG_JSON=`oc extract secret/pull-secret -n openshift-config --to=-`다음 명령을 실행하여

open-cluster-management-observability네임스페이스에 pull-secret을 생성합니다.oc create secret generic multiclusterhub-operator-pull-secret \ -n open-cluster-management-observability \ --from-literal=.dockerconfigjson="$DOCKER_CONFIG_JSON" \ --type=kubernetes.io/dockerconfigjson

중요: OpenShift Container Platform 설명서를 사용하여 클러스터의 글로벌 풀 시크릿을 수정하는 경우 Observability 네임스페이스에서 글로벌 풀 시크릿을 업데이트해야 합니다. 자세한 내용은 글로벌 풀 시크릿 업데이트를 참조하십시오.

클라우드 공급자의 오브젝트 스토리지에 대한 시크릿을 생성합니다. 시크릿에는 스토리지 솔루션에 대한 인증 정보가 포함되어야 합니다. 예를 들어 다음 명령을 실행합니다.

oc create -f thanos-object-storage.yaml -n open-cluster-management-observability지원되는 오브젝트 저장소에 대한 다음 보안 예제를 확인합니다.

Amazon S3 또는 S3 호환의 경우 시크릿은 다음 파일과 유사할 수 있습니다.

apiVersion: v1 kind: Secret metadata: name: thanos-object-storage namespace: open-cluster-management-observability type: Opaque stringData: thanos.yaml: | type: s3 config: bucket: YOUR_S3_BUCKET endpoint: YOUR_S3_ENDPOINT1 insecure: true access_key: YOUR_ACCESS_KEY secret_key: YOUR_SECRET_KEY- 1

- 프로토콜 없이 URL을 입력합니다. Amazon S3 끝점의 URL을 입력하십시오.

s3.us-east-1.amazonaws.com.

Google Cloud Platform의 경우 시크릿은 다음 파일과 유사할 수 있습니다.

apiVersion: v1 kind: Secret metadata: name: thanos-object-storage namespace: open-cluster-management-observability type: Opaque stringData: thanos.yaml: | type: GCS config: bucket: YOUR_GCS_BUCKET service_account: YOUR_SERVICE_ACCOUNT자세한 내용은 Google Cloud Storage 를 참조하십시오.

Azure의 경우 시크릿은 다음 파일과 유사할 수 있습니다.

apiVersion: v1 kind: Secret metadata: name: thanos-object-storage namespace: open-cluster-management-observability type: Opaque stringData: thanos.yaml: | type: AZURE config: storage_account: YOUR_STORAGE_ACCT storage_account_key: YOUR_STORAGE_KEY container: YOUR_CONTAINER endpoint: blob.core.windows.net1 max_retries: 0- 1

msi_resource경로를 사용하는 경우 시스템에 할당된 관리 ID를 사용하여 엔드포인트 인증이 완료됩니다. 값은https://<storage-account-name>.blob.core.windows.net끝점과 유사해야 합니다.

user_assigned_id경로를 사용하는 경우 사용자가 할당한 관리 ID를 사용하여 엔드포인트 인증이 완료됩니다.user_assigned_id를 사용하는 경우msi_resource끝점 기본값은https:<storage_account>.<endpoint>입니다. 자세한 내용은 Azure Storage 설명서를 참조하십시오.참고: Azure를 Red Hat OpenShift Container Platform 클러스터의 오브젝트 스토리지로 사용하는 경우 클러스터와 연결된 스토리지 계정이 지원되지 않습니다. 새 스토리지 계정을 생성해야 합니다.

Red Hat OpenShift Data Foundation의 경우 시크릿은 다음 파일과 유사할 수 있습니다.

apiVersion: v1 kind: Secret metadata: name: thanos-object-storage namespace: open-cluster-management-observability type: Opaque stringData: thanos.yaml: | type: s3 config: bucket: YOUR_RH_DATA_FOUNDATION_BUCKET endpoint: YOUR_RH_DATA_FOUNDATION_ENDPOINT1 insecure: false access_key: YOUR_RH_DATA_FOUNDATION_ACCESS_KEY secret_key: YOUR_RH_DATA_FOUNDATION_SECRET_KEY- 1

- 프로토콜 없이 URL을 입력합니다. 다음 URL과 유사한 Red Hat OpenShift Data Foundation 끝점의 URL을 입력합니다.

example.redhat.com:443.

자세한 내용은 Red Hat OpenShift Data Foundation 을 참조하십시오.

- Red Hat OpenShift on IBM(ROKS)의 경우 시크릿이 다음 파일과 유사할 수 있습니다.

apiVersion: v1 kind: Secret metadata: name: thanos-object-storage namespace: open-cluster-management-observability type: Opaque stringData: thanos.yaml: | type: s3 config: bucket: YOUR_ROKS_S3_BUCKET endpoint: YOUR_ROKS_S3_ENDPOINT1 insecure: true access_key: YOUR_ROKS_ACCESS_KEY secret_key: YOUR_ROKS_SECRET_KEY- 1

- 프로토콜 없이 URL을 입력합니다. 다음 URL과 유사한 Red Hat OpenShift Data Foundation 끝점의 URL을 입력합니다.

example.redhat.com:443.자세한 내용은 IBM Cloud 설명서인 Cloud Object Storage 를 참조하십시오. 서비스 자격 증명을 사용하여 오브젝트 스토리지와 연결하십시오. 자세한 내용은 IBM Cloud 문서, Cloud Object Store 및 서비스 인증 정보를 참조하십시오.

1.3.2.1. AWS 보안 토큰 서비스 스토리지 구성

Amazon S3 또는 S3 호환 스토리지의 경우 AWS STS(Security Token Service)로 생성된 단기적이고 제한된 권한 인증 정보를 사용할 수도 있습니다. 자세한 내용은 AWS Security Token Service 설명서 를 참조하십시오.

AWS Security Service를 사용하여 액세스 키를 생성하려면 다음과 같은 추가 단계가 필요합니다.

- S3 버킷에 대한 액세스를 제한하는 IAM 정책을 생성합니다.

- 신뢰 정책으로 IAM 역할을 생성하여 OpenShift Container Platform 서비스 계정에 대한 JWT 토큰을 생성합니다.

- S3 버킷에 액세스해야 하는 Observability 서비스 계정에 대한 주석을 지정합니다. AWS(ROSA) 클러스터에서 Observability on Red Hat OpenShift Service on AWS(ROSA) 클러스터는 설정 환경 단계에서 AWS STS 토큰을 사용하도록 구성할 수 있는 방법의 예를 찾을 수 있습니다. 자세한 내용은 ROSA와 함께 Red Hat OpenShift Service on AWS ( ROSA) 에서 STS와 함께 요구 사항 및 STS 토큰을 사용하도록 설정에 대한 자세한 내용을 참조하십시오.

1.3.2.2. AWS 보안 서비스를 사용하여 액세스 키 생성

AWS Security Service를 사용하여 액세스 키를 생성하려면 다음 단계를 완료합니다.

AWS 환경을 설정합니다. 다음 명령을 실행합니다.

export POLICY_VERSION=$(date +"%m-%d-%y") export TRUST_POLICY_VERSION=$(date +"%m-%d-%y") export CLUSTER_NAME=<my-cluster> export S3_BUCKET=$CLUSTER_NAME-acm-observability export REGION=us-east-2 export NAMESPACE=open-cluster-management-observability export SA=tbd export SCRATCH_DIR=/tmp/scratch export OIDC_PROVIDER=$(oc get authentication.config.openshift.io cluster -o json | jq -r .spec.serviceAccountIssuer| sed -e "s/^https:\/\///") export AWS_ACCOUNT_ID=$(aws sts get-caller-identity --query Account --output text) export AWS_PAGER="" rm -rf $SCRATCH_DIR mkdir -p $SCRATCH_DIR다음 명령을 사용하여 S3 버킷을 생성합니다.

aws s3 mb s3://$S3_BUCKETS3 버킷에 액세스할 수 있도록

s3-policyJSON 파일을 생성합니다. 다음 명령을 실행합니다.{ "Version": "$POLICY_VERSION", "Statement": [ { "Sid": "Statement", "Effect": "Allow", "Action": [ "s3:ListBucket", "s3:GetObject", "s3:DeleteObject", "s3:PutObject", "s3:PutObjectAcl", "s3:CreateBucket", "s3:DeleteBucket" ], "Resource": [ "arn:aws:s3:::$S3_BUCKET/*", "arn:aws:s3:::$S3_BUCKET" ] } ] }다음 명령을 사용하여 정책을 적용합니다.

S3_POLICY=$(aws iam create-policy --policy-name $CLUSTER_NAME-acm-obs \ --policy-document file://$SCRATCH_DIR/s3-policy.json \ --query 'Policy.Arn' --output text) echo $S3_POLICYTrustPolicyJSON 파일을 생성합니다. 다음 명령을 실행합니다.{ "Version": "$TRUST_POLICY_VERSION", "Statement": [ { "Effect": "Allow", "Principal": { "Federated": "arn:aws:iam::${AWS_ACCOUNT_ID}:oidc-provider/${OIDC_PROVIDER}" }, "Action": "sts:AssumeRoleWithWebIdentity", "Condition": { "StringEquals": { "${OIDC_PROVIDER}:sub": [ "system:serviceaccount:${NAMESPACE}:observability-thanos-query", "system:serviceaccount:${NAMESPACE}:observability-thanos-store-shard", "system:serviceaccount:${NAMESPACE}:observability-thanos-compact", "system:serviceaccount:${NAMESPACE}:observability-thanos-rule", "system:serviceaccount:${NAMESPACE}:observability-thanos-receive" ] } } } ] }다음 명령을 사용하여 AWS Prometheus 및 CloudMonitor에 대한 역할을 생성합니다.

S3_ROLE=$(aws iam create-role \ --role-name "$CLUSTER_NAME-acm-obs-s3" \ --assume-role-policy-document file://$SCRATCH_DIR/TrustPolicy.json \ --query "Role.Arn" --output text) echo $S3_ROLE역할에 정책을 연결합니다. 다음 명령을 실행합니다.

aws iam attach-role-policy \ --role-name "$CLUSTER_NAME-acm-obs-s3" \ --policy-arn $S3_POLICY시크릿은 다음 파일과 유사할 수 있습니다.

config섹션은signature_version2: false를 지정하고access_key및secret_key:을 지정하지 않습니다.apiVersion: v1 kind: Secret metadata: name: thanos-object-storage namespace: open-cluster-management-observability type: Opaque stringData: thanos.yaml: | type: s3 config: bucket: $S3_BUCKET endpoint: s3.$REGION.amazonaws.com signature_version2: false-

MultiClusterObservability사용자 정의 리소스 섹션에 설명된 대로 MultiClusterObservability 사용자 정의 리소스에서 서비스 계정 주석을 지정합니다. 다음 명령을 사용하여 클라우드 공급자의 S3 액세스 키 및 시크릿 키를 검색합니다.

base64문자열을 시크릿에 디코딩, 편집 및 인코딩해야 합니다.클라우드 공급자에 대한 S3 액세스 키를 편집하고 디코딩하려면 다음 명령을 실행합니다.

YOUR_CLOUD_PROVIDER_ACCESS_KEY=$(oc -n open-cluster-management-observability get secret <object-storage-secret> -o jsonpath="{.data.thanos\.yaml}" | base64 --decode | grep access_key | awk '{print $2}')클라우드 공급자의 액세스 키를 보려면 다음 명령을 실행합니다.

echo $YOUR_CLOUD_PROVIDER_ACCESS_KEY클라우드 공급자의 시크릿 키를 편집하고 디코딩하려면 다음 명령을 실행합니다.

YOUR_CLOUD_PROVIDER_SECRET_KEY=$(oc -n open-cluster-management-observability get secret <object-storage-secret> -o jsonpath="{.data.thanos\.yaml}" | base64 --decode | grep secret_key | awk '{print $2}')- 다음 명령을 실행하여 클라우드 공급자의 시크릿 키를 확인합니다.

echo $YOUR_CLOUD_PROVIDER_SECRET_KEYPod에서 다음 배포 및 상태 저장 세트가 있는지 확인하여 Observability가 활성화되어 있는지 확인합니다. 다음 정보를 받을 수 있습니다.

observability-thanos-query (deployment) observability-thanos-compact (statefulset) observability-thanos-receive-default (statefulset) observability-thanos-rule (statefulset) observability-thanos-store-shard-x (statefulsets)

1.3.2.3. MultiClusterObservability 사용자 정의 리소스 생성

MultiClusterObservability 사용자 정의 리소스를 사용하여 다양한 구성 요소의 영구 볼륨 스토리지 크기를 지정합니다. MultiClusterObservability 사용자 정의 리소스를 처음 생성하는 동안 스토리지 크기를 설정해야 합니다. 스토리지 크기 값을 배포 후 업데이트할 때 스토리지 클래스가 동적 볼륨 확장을 지원하는 경우에만 변경 사항이 적용됩니다. 자세한 내용은 Red Hat OpenShift Container Platform 설명서에서 영구 볼륨 확장을 참조하십시오.

hub 클러스터에서 MultiClusterObservability 사용자 정의 리소스를 생성하려면 다음 단계를 완료합니다.

multiclusterobservability_cr.yaml이라는MultiClusterObservability사용자 정의 리소스 YAML 파일을 생성합니다.관찰을 위해 다음과 같은 기본 YAML 파일을 확인합니다.

apiVersion: observability.open-cluster-management.io/v1beta2 kind: MultiClusterObservability metadata: name: observability spec: observabilityAddonSpec: {} storageConfig: metricObjectStorage: name: thanos-object-storage key: thanos.yamladvanced섹션에서retentionConfig매개변수 값을 수정할 수 있습니다. 자세한 내용은 Thanos Downsampling resolution and retention 에서 참조하십시오. 관리 클러스터 수에 따라 상태 저장 세트의 스토리지 양을 업데이트할 수 있습니다. S3 버킷이 STS 토큰을 사용하도록 구성된 경우 S3 역할과 함께 STS를 사용하도록 서비스 계정에 주석을 답니다. 다음 구성을 확인합니다.spec: advanced: compact: serviceAccountAnnotations: eks.amazonaws.com/role-arn: $S3_ROLE store: serviceAccountAnnotations: eks.amazonaws.com/role-arn: $S3_ROLE rule: serviceAccountAnnotations: eks.amazonaws.com/role-arn: $S3_ROLE receive: serviceAccountAnnotations: eks.amazonaws.com/role-arn: $S3_ROLE query: serviceAccountAnnotations: eks.amazonaws.com/role-arn: $S3_ROLE자세한 내용은 Observability API 를 참조하십시오.

인프라 머신 세트에 배포하려면

MultiClusterObservabilityYAML에서nodeSelector를 업데이트하여 설정된 레이블을 설정해야 합니다. YAML은 다음 콘텐츠와 유사할 수 있습니다.nodeSelector: node-role.kubernetes.io/infra: ""자세한 내용은 인프라 머신 세트 생성 을 참조하십시오.

다음 명령을 실행하여 Observability YAML을 클러스터에 적용합니다.

oc apply -f multiclusterobservability_cr.yaml참고: 기본적으로

MultiClusterObservability사용자 정의 리소스에서storageConfig.storageClass필드를 정의하지 않으면 플랫폼 기본StorageClass필드는MultiClusterObservability리소스의storageConfig섹션에 채워집니다. 예를 들어 AWS 기본storageClass는gp2로 설정됩니다.다음 명령을 실행하여 기본

storageClass를 확인합니다.oc get storageClass다음 예제 출력을 참조하십시오.

NAME PROVISIONER RECLAIMPOLICY VOLUMEBINDINGMODE ALLOWVOLUMEEXPANSION AGE gp2-csi ebs.csi.aws.com Delete WaitForFirstConsumer true 151m gp3-csi (default) ebs.csi.aws.com Delete WaitForFirstConsumer true 151m- Grafana 대시보드를 시작하여 Observability 서비스가 활성화되고 데이터가 입력되었는지 확인합니다.

- 콘솔 개요 페이지 또는 Clusters 페이지에서 콘솔 헤더 옆에 있는 Grafana 링크를 클릭합니다.

multicluster-observability-operator배포에 액세스하여multicluster-observability-operatorPod가multiclusterhub-operator배포에 의해 배포되고 있는지 확인합니다. 다음 명령을 실행합니다.oc get deploy multicluster-observability-operator -n open-cluster-management --show-labels다음 결과가 표시될 수 있습니다.

NAME READY UP-TO-DATE AVAILABLE AGE LABELS multicluster-observability-operator 1/1 1 1 35m installer.name=multiclusterhub,installer.namespace=open-cluster-management리소스와 연결된

라벨에 대한multicluster-observability-operator배포의 labels 섹션을 확인합니다.labels섹션에는 다음 세부 정보가 포함될 수 있습니다.labels: installer.name: multiclusterhub installer.namespace: open-cluster-management-

선택 사항: 특정 관리 클러스터에서 Observability 데이터를 수집하는 것을 제외하려면

observability: disabled라는 클러스터에 다음 클러스터 레이블을 추가합니다.

Observability 서비스가 활성화되어 있습니다. Observability 서비스를 활성화하면 다음 기능이 시작됩니다.

- 관리 클러스터의 모든 경고 관리자는 Red Hat Advanced Cluster Management Hub 클러스터로 전달됩니다.

Red Hat Advanced Cluster Management Hub 클러스터에 연결된 모든 관리형 클러스터는 Red Hat Advanced Cluster Management Observability 서비스로 경고를 다시 보낼 수 있습니다. 이메일, PagerDuty 또는 OpsGenie와 같은 올바른 수신자 통합으로 경고를 중복, 그룹화 및 라우팅하도록 Red Hat Advanced Cluster Management Alertmanager를 구성할 수 있습니다. 또한 경고의 실크 및 억제를 처리할 수 있습니다.

참고: Red Hat Advanced Cluster Management Hub 클러스터 기능에 대한 경고는 지원되는 OpenShift Container Platform 버전의 관리 클러스터에서만 지원됩니다. Observability가 활성화된 Red Hat Advanced Cluster Management를 설치한 후 허브 클러스터로 경고가 자동으로 전달됩니다. 자세한 내용은 경고 전달을 참조하십시오.

1.3.3. Red Hat OpenShift Container Platform 콘솔에서 Observability 활성화

선택적으로 Red Hat OpenShift Container Platform 콘솔에서 Observability를 활성화하고 open-cluster-management-observability 라는 프로젝트를 생성할 수 있습니다. 다음 단계를 완료합니다.

-

open-cluster-management-observability프로젝트에서multiclusterhub-operator-pull-secret이라는 이미지 풀 시크릿을 생성합니다. -

open-cluster-management-observability프로젝트에서thanos-object-storage라는 오브젝트 스토리지 시크릿을 생성합니다. - 오브젝트 스토리지 시크릿 세부 정보를 입력하고 생성 을 클릭합니다. 보안 예제 를 보려면 Observability 섹션의 4단계를 참조하십시오.

-

MultiClusterObservability사용자 정의 리소스 인스턴스를 생성합니다. 다음 메시지가 표시되면 OpenShift Container Platform에서 Observability 서비스가 성공적으로 활성화됩니다.Observability 구성 요소가 배포되고 실행 중입니다.

1.3.3.1. Thanos 버전 확인

Thanos가 클러스터에 배포된 후 CLI(명령줄 인터페이스)에서 Thanos 버전을 확인합니다.

hub 클러스터에 로그인한 후 Observability Pod에서 다음 명령을 실행하여 Thanos 버전을 수신합니다.

thanos --versionThanos 버전이 표시됩니다.

1.3.4. Observability 비활성화

Red Hat Advanced Cluster Management Hub 클러스터에서 데이터 수집을 중지하는 Observability를 비활성화할 수 있습니다.

1.3.4.1. 모든 클러스터에서 Observability 비활성화

모든 관리 클러스터에서 Observability 구성 요소를 제거하여 Observability를 비활성화합니다.

enableMetrics 를 false 로 설정하여 multicluster-observability-operator 리소스를 업데이트합니다. 업데이트된 리소스는 다음 변경 사항과 유사할 수 있습니다.

spec:

imagePullPolicy: Always

imagePullSecret: multiclusterhub-operator-pull-secret

observabilityAddonSpec:

enableMetrics: false

workers: - 1

- Observa

bilityAddonSpec매개변수를 사용하여 Observability 애드온이 활성화된 모든 관리 클러스터에 대한 글로벌 설정을 정의합니다. - 2

enableMetrics매개변수를 사용하여 메트릭을 hub 클러스터 서버로 내보낼 수 있도록 Observability 애드온이 활성화되어 있음을 나타냅니다.- 3

- 기술 프리뷰:

workers매개변수를 사용하여 지표 수집기 프로세스의 내부 작업자 수를 늘립니다. 내부 작업자 shard/federate관리 클러스터에서 Prometheus에 대한 끝점 요청을 제공하고 허브 클러스터의 Thanos에 별도의 원격 쓰기 요청을 보냅니다.

1.3.4.2. 단일 클러스터에서 Observability 비활성화

특정 관리 클러스터에서 Observability 구성 요소를 제거하여 Observability를 비활성화합니다. 다음 단계를 완료합니다.

-

managedclusters.cluster.open-cluster-management.io사용자 정의 리소스에observability: disabled레이블을 추가합니다. Red Hat Advanced Cluster Management 콘솔 Clusters 페이지에서

observability=disabled라벨을 지정된 클러스터에 추가합니다.참고: Observability 구성 요소가 있는 관리형 클러스터가 분리되면

메트릭 수집배포가 제거됩니다.

1.3.5. Observability 제거

MultiClusterObservability 사용자 정의 리소스를 제거하면 Observability 서비스를 비활성화하고 제거합니다. OpenShift Container Platform 콘솔 탐색에서 Operator > 설치된 Operator > Advanced Cluster Manager for Kubernetes 를 선택합니다. MultiClusterObservability 사용자 정의 리소스를 제거합니다.

1.3.6. 추가 리소스

오브젝트 스토리지 정보에 대한 클라우드 공급자 설명서 링크:

- Observability 사용을 참조하십시오.

- Observability 서비스 사용자 지정에 대한 자세한 내용은 Observability 사용자 지정을 참조하십시오.

- 더 많은 관련 주제를 보려면 Observability 서비스로 돌아갑니다.

1.4. 관찰 기능 구성 사용자 정의

관찰 기능을 활성화한 후 환경의 특정 요구 사항에 맞게 관찰 기능 구성을 사용자 지정합니다. 관찰 기능 서비스에서 수집하는 클러스터 플릿 데이터를 관리하고 확인합니다.

필수 액세스: 클러스터 관리자

1.4.1. 사용자 정의 규칙 생성

관찰 가능성 리소스에 Prometheus 기록 규칙 및 경고 규칙을 추가하여 관찰 기능 설치에 대한 사용자 정의 규칙을 생성합니다.

비용이 많이 드는 표현식을 미리 계산하려면 Prometheus와 함께 레코딩 규칙 기능을 사용하여 경고 조건을 생성하고 외부 서비스에 경고를 보내는 방법에 따라 알림을 보냅니다. 결과는 새로운 시계열로 저장됩니다. thanos-ruler-custom-rules 구성 맵 내에 사용자 정의 경고 규칙을 생성하려면 다음 예제를 확인합니다.

CPU 사용량이 정의된 값을 전달할 때 알림을 받으려면 다음 사용자 정의 경고 규칙을 생성합니다.

data: custom_rules.yaml: | groups: - name: cluster-health rules: - alert: ClusterCPUHealth-jb annotations: summary: Notify when CPU utilization on a cluster is greater than the defined utilization limit description: "The cluster has a high CPU usage: {{ $value }} core for {{ $labels.cluster }} {{ $labels.clusterID }}." expr: | max(cluster:cpu_usage_cores:sum) by (clusterID, cluster, prometheus) > 0 for: 5s labels: cluster: "{{ $labels.cluster }}" prometheus: "{{ $labels.prometheus }}" severity: critical참고:

-

사용자 지정 규칙을 업데이트하면

observability-thanos-rulePod가 자동으로 다시 시작됩니다. - 구성에 여러 규칙을 생성할 수 있습니다.

-

기본 경고 규칙은

open-cluster-management-observability네임스페이스의observability-thanos-rule-default-rules구성 맵에 있습니다.

-

사용자 지정 규칙을 업데이트하면

Pod의 컨테이너 메모리 캐시 합계를 가져오는 사용자 정의 레코딩 규칙을 생성하려면 다음 사용자 정의 규칙을 생성합니다.

data: custom_rules.yaml: | groups: - name: container-memory rules: - record: pod:container_memory_cache:sum expr: sum(container_memory_cache{pod!=""}) BY (pod, container)참고: 구성 맵을 변경한 후 구성이 자동으로 다시 로드됩니다.

observability-thanos-rule사이드카 내의config-reload로 인해 구성이 다시 로드됩니다.

경고 규칙이 올바르게 작동하는지 확인하려면 Grafana 대시보드로 이동하여 탐색 페이지를 선택하고 ALERTS 를 쿼리합니다. 경고를 생성한 경우에만 Grafana에서 경고를 사용할 수 있습니다.

1.4.2. 사용자 정의 메트릭 추가

Kubernetes용 Red Hat Advanced Cluster Management를 사용하여 원격 클러스터에서 메트릭을 모니터링하려면 메트릭이 Platform 또는 사용자 워크로드 메트릭으로 내보내졌는지 확인합니다. 다음 세 가지 방법 중 하나를 사용하여 메트릭 유형을 찾습니다.

- 모니터링할 솔루션 설명서에서 메트릭 유형을 찾습니다.

- 제품의 지원에 문의하여 메트릭 유형을 찾습니다.

ServiceMonitor가 관찰된 리소스 사용에 대한 주석을 확인하여 지표 유형을 찾습니다.-

플랫폼 메트릭은

operator.prometheus.io/controller-id: openshift-platform-monitoring/prometheus-operator를 사용합니다. -

사용자 워크로드 메트릭은

operator.prometheus.io/controller-id: openshift-user-workload-monitoring/prometheus-operator를 사용합니다.

-

플랫폼 메트릭은

Observe > Targets 로 이동하여 오른쪽 상단의 소스 필터에서 플랫폼 또는 사용자를 선택하여 콘솔에서 ServiceMonitor 를 찾을 수도 있습니다.

참고: 소스 필터는 메트릭 목록이 아닌 서비스 모니터 또는 대상 정보를 제공합니다.

메트릭이 플랫폼인 경우 플랫폼 메트릭 추가 에서 계속합니다. 메트릭이 사용자 워크로드인 경우 사용자 워크로드 지표 추가 에서 계속합니다.

1.4.2.1. 플랫폼 메트릭 추가

open-cluster-management-observability 네임스페이스의 hub 클러스터에 ConfigMap 을 생성하여 플랫폼 메트릭을 모니터링할 수 있습니다. 이름으로 observability-metrics-custom-allowlist 를 사용합니다. 플랫폼 메트릭을 모니터링하는 데 사용할 수 있는 다음 ConfigMap 예제를 참조하십시오.

kind: ConfigMap

apiVersion: v1

metadata:

name: observability-metrics-custom-allowlist

namespace: open-cluster-management-observability

data:

metrics_list.yaml: |

names:

- node_memory_MemTotal_bytes

recording_rules:

- record: apiserver_request_duration_seconds:histogram_quantile_90

expr: histogram_quantile(0.90,sum(rate(apiserver_request_duration_seconds_bucket {job=\"apiserver\", verb!=\"WATCH\"}[5m])) by (verb,le))

수집하는 메트릭의 이름은 관리 클러스터 레코드 매개변수에 정의된 이름과 같습니다. 쿼리 표현식을 실행한 후 메트릭 값 결과가 표시됩니다. 모니터링이 활성화된 모든 클러스터에 적용되는 하나의 섹션 또는 두 섹션을 사용할 수 있습니다.

단일 관리 클러스터에서만 사용자 정의 메트릭을 수집하려면 다음 예제를 사용하고 open-cluster-management-addon-observability 네임스페이스의 관리 클러스터에 구성 맵을 적용합니다.

kind: ConfigMap

apiVersion: v1

metadata:

name: observability-metrics-custom-allowlist

namespace: open-cluster-management-addon-observability

data:

metrics_list.yaml: |

names:

- node_memory_MemTotal_bytes

recording_rules:

- record: apiserver_request_duration_seconds:histogram_quantile_90

expr: histogram_quantile(0.90,sum(rate(apiserver_request_duration_seconds_bucket{job="apiserver", verb!="WATCH"}[5m])) by (verb,le))

수집하는 메트릭의 이름은 관리 클러스터 레코드 매개변수에 정의된 이름과 같습니다. 쿼리 표현식을 실행한 후 메트릭 값 결과가 표시됩니다. 하나의 섹션 또는 두 섹션을 모두 사용할 수 있습니다.

1.4.2.2. 사용자 워크로드 메트릭 추가

메트릭을 캡처하려는 네임스페이스에서 관리 클러스터에 대한 구성을 설정하여 사용자 워크로드 지표를 모니터링할 수 있습니다. name은 observability-metrics-custom-allowlist 여야 하며 형식은 다음 예와 동일해야 합니다.

kind: ConfigMap

apiVersion: v1

metadata:

name: observability-metrics-custom-allowlist

namespace: <monitored_namespace>

data:

uwl_metrics_list.yaml:

names:

- <sample_metrics>

이전 예제에서는 namespace monitored_namespace 에서 User 워크로드 지표 sample_metrics 를 모니터링합니다. 대신 open-cluster-management-addon-observability 네임스페이스에 구성을 생성하면 관리 클러스터의 모든 네임스페이스에서 메트릭이 수집됩니다.

1.4.2.3. 기본 메트릭 제거

관리 클러스터에서 특정 메트릭에 대한 데이터를 수집하지 않으려면 observability-metrics-custom-allowlist.yaml 파일에서 지표를 제거합니다. 지표를 제거하면 관리 클러스터에서 지표 데이터가 수집되지 않습니다. 기본 메트릭을 제거하려면 다음 단계를 완료합니다.

다음 명령을 사용하여

mco observability가 활성화되어 있는지 확인합니다.oc get mco observability -o yaml메트릭 이름 시작 시 하이픈

-을 사용하여 기본 메트릭의 이름을metrics_list.yaml매개변수에 추가합니다. 다음 메트릭 예제를 확인합니다.-cluster_infrastructure_provider다음 명령을 사용하여

open-cluster-management-observability네임스페이스에observability-metrics-custom-allowlist구성 맵을 생성합니다.oc apply -n open-cluster-management-observability -f observability-metrics-custom-allowlist.yaml- 관찰 기능 서비스가 관리 클러스터에서 특정 지표를 수집하지 않는지 확인합니다. Grafana 대시보드에서 지표를 쿼리하면 지표가 표시되지 않습니다.

1.4.3. 보존을 위한 고급 구성 추가

필요에 따라 각 관찰 가능성 구성 요소의 보존을 업데이트하려면 고급 구성 섹션을 추가합니다. 다음 단계를 완료합니다.

다음 명령을 사용하여

MultiClusterObservability사용자 정의 리소스를 편집합니다.oc edit mco observability -o yaml고급섹션을 파일에 추가합니다. YAML 파일은 다음 내용과 유사할 수 있습니다.spec: advanced: retentionConfig: blockDuration: 2h deleteDelay: 48h retentionInLocal: 24h retentionResolutionRaw: 365d retentionResolution5m: 365d retentionResolution1h: 365d receive: resources: limits: memory: 4096Gi replicas: 3참고:

-

고급구성에 추가할 수 있는 모든 매개변수에 대한 설명은 Observability API 설명서를 참조하십시오. -

retentionResolutionRaw,retentionResolution5m또는retentionResolution1h와 같은 모든 해결 수준에 대한 기본 보존은 365 일 (365d)입니다.MultiClusterObservabilityspec.advanced.retentionConfig매개변수에서 해결 보존에 대한 명시적 값을 설정해야 합니다.

-

이전 버전에서 업그레이드하고 해당 버전 보존 구성을 유지하려면 이전에 언급한 구성을 추가합니다. 다음 단계를 완료합니다.

다음 명령을 실행하여

MultiClusterObservability리소스로 이동합니다.oc edit mco observability-

spec.advanced.retentionConfig매개변수에서 다음 구성을 적용합니다.

spec: advanced: retentionConfig: retentionResolutionRaw: 365d retentionResolution5m: 365d retentionResolution1h: 365d

1.4.4. 단일 노드 OpenShift 클러스터에 대한 동적 메트릭

동적 메트릭 컬렉션은 특정 조건에 따라 자동 메트릭 컬렉션을 지원합니다. 기본적으로 단일 노드 OpenShift 클러스터는 포드 및 컨테이너 리소스 지표를 수집하지 않습니다. 단일 노드 OpenShift 클러스터가 특정 리소스 소비 수준에 도달하면 정의된 세분화된 메트릭이 동적으로 수집됩니다. 일정 기간 동안 클러스터 리소스 사용량이 임계값보다 일관되게 작으면 세분화된 메트릭 수집이 중지됩니다.

메트릭은 컬렉션 규칙에 의해 지정된 관리 클러스터의 조건에 따라 동적으로 수집됩니다. 이러한 메트릭은 동적으로 수집되므로 다음 Red Hat Advanced Cluster Management Grafana 대시보드는 데이터를 표시하지 않습니다. 컬렉션 규칙이 활성화되고 해당 메트릭이 수집되면 다음 패널은 수집 규칙이 시작되는 기간 동안 데이터를 표시합니다.

- Kubernetes/Compute 리소스/네임스페이스(Pods)

- Kubernetes/Compute 리소스/네임스페이스(워크로드)

- Kubernetes/Compute 리소스/노드(Pods)

- Kubernetes/Compute 리소스/Pod

- Kubernetes/Compute Resources/Workload 컬렉션 규칙에는 다음 조건이 포함됩니다.

- 동적으로 수집할 지표 세트입니다.

- PromQL 표현식으로 작성된 조건입니다.

-

컬렉션의 시간 간격을

true로 설정해야 합니다. - 수집 규칙을 평가해야 하는 클러스터를 선택하는 일치 표현식입니다.

기본적으로 컬렉션 규칙은 관리 클러스터에서 30초마다 또는 특정 시간 간격으로 지속적으로 평가됩니다. 컬렉션 간격과 시간 간격 사이의 가장 낮은 값이 우선합니다. for 속성에서 지정한 기간 동안 컬렉션 규칙 조건이 지속되면 컬렉션 규칙이 시작되고 규칙에서 지정한 메트릭이 관리 클러스터에서 자동으로 수집됩니다. 메트릭 컬렉션은 컬렉션 규칙 조건이 더 이상 관리 클러스터에 없는 후 15분 이상 시작된 후 자동으로 중지됩니다.

컬렉션 규칙은 collect_rules 라는 매개 변수 섹션으로 그룹화됩니다. 여기서 그룹으로 활성화하거나 비활성화할 수 있습니다. Red Hat Advanced Cluster Management 설치에는 HighCPUUsage 및 HighMemoryUsage 의 두 가지 기본 컬렉션 규칙이 있는 SNOResourceUsage SNOResourceUsage가 포함되어 있습니다. 노드 CPU 사용량이 70%를 초과하면 HighCPUUsage 컬렉션 규칙이 시작됩니다. HighMemoryUsage 컬렉션 규칙은 단일 노드 OpenShift 클러스터의 전체 메모리 사용률이 사용 가능한 노드 메모리의 70%를 초과하면 시작됩니다. 현재는 앞서 언급한 임계값이 고정되어 있으며 변경할 수 없습니다. for 속성에 의해 지정된 간격보다 많은 컬렉션 규칙이 시작되면 시스템은 dynamic_metrics 섹션에 지정된 메트릭 수집이 자동으로 시작됩니다.

다음 YAML 파일에서 collect_rules 섹션의 동적 메트릭 목록을 확인합니다.

collect_rules:

- group: SNOResourceUsage

annotations:

description: >

By default, a {sno} cluster does not collect pod and container resource metrics. Once a {sno} cluster

reaches a level of resource consumption, these granular metrics are collected dynamically.

When the cluster resource consumption is consistently less than the threshold for a period of time,

collection of the granular metrics stops.

selector:

matchExpressions:

- key: clusterType

operator: In

values: ["{sno}"]

rules:

- collect: SNOHighCPUUsage

annotations:

description: >

Collects the dynamic metrics specified if the cluster cpu usage is constantly more than 70% for 2 minutes

expr: (1 - avg(rate(node_cpu_seconds_total{mode=\"idle\"}[5m]))) * 100 > 70

for: 2m

dynamic_metrics:

names:

- container_cpu_cfs_periods_total

- container_cpu_cfs_throttled_periods_total

- kube_pod_container_resource_limits

- kube_pod_container_resource_requests

- namespace_workload_pod:kube_pod_owner:relabel

- node_namespace_pod_container:container_cpu_usage_seconds_total:sum_irate

- node_namespace_pod_container:container_cpu_usage_seconds_total:sum_rate

- collect: SNOHighMemoryUsage

annotations:

description: >

Collects the dynamic metrics specified if the cluster memory usage is constantly more than 70% for 2 minutes

expr: (1 - sum(:node_memory_MemAvailable_bytes:sum) / sum(kube_node_status_allocatable{resource=\"memory\"})) * 100 > 70

for: 2m

dynamic_metrics:

names:

- kube_pod_container_resource_limits

- kube_pod_container_resource_requests

- namespace_workload_pod:kube_pod_owner:relabel

matches:

- __name__="container_memory_cache",container!=""

- __name__="container_memory_rss",container!=""

- __name__="container_memory_swap",container!=""

- __name__="container_memory_working_set_bytes",container!=""

다음 예와 같이 collect_rules.group 을 custom-allowlist 에서 비활성화할 수 있습니다. collect_rules.group 을 비활성화하면 메트릭 컬렉션이 이전 동작으로 되돌아갑니다. 이러한 메트릭은 지정된 간격으로 수집됩니다.

collect_rules:

- group: -SNOResourceUsage이 데이터는 규칙이 시작될 때 Grafana에만 표시됩니다.

1.4.5. 콘솔에서 MultiClusterObservability 사용자 정의 리소스 복제본 업데이트

워크로드가 증가하면 관찰 기능 Pod의 복제본 수를 늘립니다. hub 클러스터에서 Red Hat OpenShift Container Platform 콘솔로 이동합니다. MultiClusterObservability 사용자 정의 리소스를 찾고 복제본을 변경하려는 구성 요소의 replicas 매개변수 값을 업데이트합니다. 업데이트된 YAML은 다음 콘텐츠와 유사할 수 있습니다.

spec:

advanced:

receive:

replicas: 6

mco observability 사용자 정의 리소스 내의 매개변수에 대한 자세한 내용은 Observability API 설명서를 참조하십시오.

1.4.6. 영구 볼륨 및 영구 볼륨 클레임 증가 및 감소

영구 볼륨 및 영구 볼륨 클레임을 늘리고 줄여 스토리지 클래스의 스토리지 양을 변경합니다. 다음 단계를 완료합니다.

-

스토리지 클래스가 볼륨 확장을 지원하는 경우 영구 볼륨의 크기를 늘리려면

MultiClusterObservability사용자 정의 리소스를 업데이트합니다. 영구 볼륨의 크기를 줄이려면 영구 볼륨을 사용하여 Pod를 제거한 후 영구 볼륨을 삭제하고 다시 생성합니다. 영구 볼륨에서 데이터 손실이 발생할 수 있습니다. 다음 단계를 완료합니다.

-

MultiClusterObservability사용자 정의 리소스에 주석mco-pause: "true"주석을 추가하여MultiClusterObservabilityOperator를 일시 중지합니다. 원하는 구성 요소의 상태 저장 세트 또는 배포를 찾습니다. 복제본 수를

0으로 변경합니다. 이렇게 하면 종료가 시작되어 데이터 손실을 방지하는 데 적용 가능한 경우 로컬 데이터를 업로드해야 합니다. 예를 들어 ThanosReceivestateful 세트의 이름은observability-thanos-receive-default이며 기본적으로 세 개의 복제본이 있습니다. 따라서 다음과 같은 영구 볼륨 클레임을 찾고 있습니다.-

data-observability-thanos-receive-default-0 -

data-observability-thanos-receive-default-1 -

data-observability-thanos-receive-default-2

-

- 원하는 구성 요소에서 사용하는 영구 볼륨 및 영구 볼륨 클레임을 삭제합니다.

-

MultiClusterObservability사용자 정의 리소스에서 구성 요소의 스토리지 크기를 스토리지 크기 필드에 원하는 양으로 편집합니다. 구성 요소 이름을 접두사로 지정합니다. -

이전에 추가한 주석을 제거하여

MultiClusterObservabilityOperator의 일시 중지를 해제합니다. -

Operator를 일시 중지한 후 재조정을 시작하려면

multicluster-observability-operator및observatorium-operatorPod를 삭제합니다. Pod가 즉시 다시 생성되고 조정됩니다.

-

-

MultiClusterObservability사용자 정의 리소스를 확인하여 영구 볼륨 및 볼륨 클레임이 업데이트되었는지 확인합니다.

1.4.7. 경로 인증서 사용자 정의

OpenShift Container Platform 경로 인증을 사용자 지정하려면 alt_names 섹션에 경로를 추가해야 합니다. OpenShift Container Platform 경로에 액세스할 수 있도록 하려면 alertmanager.apps.<domainname> , > , observatorium-api.apps.<domainnamerbac-query-proxy.apps.<domainname > 이라는 정보를 추가합니다.

자세한 내용은 Governance 문서의 alertmanager 경로에 대한 인증서 교체 를 참조하십시오.

참고: 사용자는 인증서 교체 및 업데이트를 담당합니다.

1.4.8. 오브젝트 저장소에 액세스하기 위한 인증서 사용자 정의

인증 기관이 포함된 Secret 리소스를 생성하고 MultiClusterObservability 사용자 정의 리소스를 구성하여 observability 오브젝트 저장소를 사용하여 보안 연결을 구성할 수 있습니다. 다음 단계를 완료합니다.

오브젝트 저장소 연결을 검증하려면 다음 명령을 사용하여 인증 기관이 포함된 파일에

Secret오브젝트를 생성합니다.oc create secret generic <tls_secret_name> --from-file=ca.crt=<path_to_file> -n open-cluster-management-observability- 또는 다음 YAML을 적용하여 보안을 생성할 수 있습니다.

apiVersion: v1 kind: Secret metadata: name: <tls_secret_name> namespace: open-cluster-management-observability type: Opaque data: ca.crt: <base64_encoded_ca_certificate>선택 사항: 상호 TLS를 활성화하려면 이전 시크릿에

public.crt및private.key키를 추가해야 합니다.다음 명령을 사용하여

metricObjectStorage섹션에 TLS 시크릿 세부 정보를 추가합니다.oc edit mco observability -o yaml파일은 다음 YAML과 유사할 수 있습니다.

metricObjectStorage: key: thanos.yaml name: thanos-object-storage tlsSecretName: tls-certs-secret1 tlsSecretMountPath: /etc/<s3-directory>/certs2 인증서 세부 정보와 함께

http_config.tls_config섹션을 추가하여thanos-object-storage시크릿에서thanos.yaml정의를 업데이트합니다. 다음 예제를 확인합니다. 필요한 경우 값을 바꿉니다.thanos.yaml: | type: s3 config: bucket: <bucket-name> endpoint: <s3.port> insecure: false1 access_key: <s3-access> secret_key: <s3-secret> http_config: tls_config: ca_file: /etc/<s3-directory>/certs/ca.crt2 insecure_skip_verify: false선택 사항: 상호 TLS를 활성화하려면

cert_file및key_file키를tls_config섹션에 추가해야 합니다. 다음 예제를 참조하십시오. 필요한 경우 값을 바꿉니다.thanos.yaml: | type: s3 config: bucket: <bucket-name> endpoint: <s3.port> insecure: false access_key: <s3-access> secret_key: <s3-secret> http_config: tls_config: ca_file: /etc/<s3-directory>/certs/ca.crt1 cert_file: /etc/<s3-directory>/certs/public.crt key_file: /etc/<s3-directory>/certs/private.key insecure_skip_verify: false- 1

ca_file,cert_file,key_file의 경로는MultiClusterObservability사용자 정의 리소스의tlsSecretMountPath와 일치해야 합니다.ca.crt,public.crt,private.crt는tls_secret_name>Secret리소스의 각 키와 일치해야 합니다.

오브젝트 저장소에 액세스할 수 있는지 확인하려면 Pod가 배포되었는지 확인합니다. 다음 명령을 실행합니다.

oc -n open-cluster-management-observability get pods -l app.kubernetes.io/name=thanos-store

1.4.9. 관찰 기능 애드온에 대한 프록시 설정 구성

관리 클러스터의 통신이 HTTP 및 HTTPS 프록시 서버를 통해 hub 클러스터에 액세스할 수 있도록 프록시 설정을 구성합니다. 일반적으로 애드온은 허브 클러스터와 관리 클러스터 간에 HTTP 및 HTTPS 프록시 서버를 지원하기 위해 특별한 구성이 필요하지 않습니다. 그러나 관찰 기능 애드온을 활성화한 경우 프록시 구성을 완료해야 합니다.

1.4.10. 사전 요구 사항

- 허브 클러스터가 있어야 합니다.

- hub 클러스터와 관리 클러스터 간에 프록시 설정을 활성화했습니다.

관찰 기능 애드온에 대한 프록시 설정을 구성하려면 다음 단계를 완료합니다.

- hub 클러스터의 클러스터 네임스페이스로 이동합니다.

spec.proxyConfig매개변수를 추가하여 프록시 설정으로AddOnDeploymentConfig리소스를 생성합니다. 다음 YAML 예제를 확인합니다.apiVersion: addon.open-cluster-management.io/v1alpha1 kind: AddOnDeploymentConfig metadata: name: <addon-deploy-config-name> namespace: <managed-cluster-name> spec: agentInstallNamespace: open-cluster-management-addon-observability proxyConfig: httpsProxy: "http://<username>:<password>@<ip>:<port>"1 noProxy: ".cluster.local,.svc,172.30.0.1"2 IP 주소를 가져오려면 관리 클러스터에서 다음 명령을 실행합니다.

oc -n default describe svc kubernetes | grep IP:ManagedClusterAddOn리소스로 이동하여 수행한AddOnDeploymentConfig리소스를 참조하여 업데이트합니다. 다음 YAML 예제를 확인합니다.apiVersion: addon.open-cluster-management.io/v1alpha1 kind: ManagedClusterAddOn metadata: name: observability-controller namespace: <managed-cluster-name> spec: installNamespace: open-cluster-management-addon-observability configs: - group: addon.open-cluster-management.io resource: addondeploymentconfigs name: <addon-deploy-config-name> namespace: <managed-cluster-name>프록시 설정을 확인합니다. 프록시 설정을 성공적으로 구성한 경우 관리 클러스터의 관찰 기능 에이전트에 의해 배포된 지표 수집기는 허브 클러스터로 데이터를 보냅니다. 다음 단계를 완료합니다.

- hub 클러스터로 이동한 다음 Grafana 대시보드의 관리 클러스터로 이동합니다.

- 프록시 설정에 대한 메트릭을 확인합니다.

1.4.11. 관찰 기능 애드온에 대한 프록시 설정 비활성화

개발이 필요한 경우 hub 클러스터 및 관리 클러스터에 대해 구성한 관찰 기능 애드온에 대한 프록시 설정을 비활성화해야 할 수 있습니다. 언제든지 관찰 기능 애드온의 프록시 설정을 비활성화할 수 있습니다. 다음 단계를 완료합니다.

-

ManagedClusterAddOn리소스로 이동합니다. -

참조된

AddOnDeploymentConfig리소스를 제거합니다.

1.4.12. 관리형 클러스터 Observatorium API 및 Alertmanager URL 사용자 정의 (기술 프리뷰)

로드 밸런서 또는 예약 프록시를 사용할 때 관리 클러스터가 허브 클러스터와 통신하는 데 사용하는 Observatorium API 및 Alertmanager URL을 사용자 지정하여 모든 Red Hat Advanced Cluster Management 기능을 유지 관리할 수 있습니다. URL을 사용자 지정하려면 다음 단계를 완료합니다.

-

MultiClusterObservability사양의고급섹션에 URL을 추가합니다. 다음 예제를 참조하십시오.

spec:

advanced:

customObservabilityHubURL: <yourURL>

customAlertmanagerHubURL: <yourURL>참고:

-

HTTPS URL만 지원됩니다. URL에

https://를 추가하지 않으면 스키마가 자동으로 추가됩니다. -

customObservabilityHubURL사양에Remote Write API의 표준 경로/api/metrics/v1/default/api/v1/receive를 포함할 수 있습니다. 경로를 포함하지 않으면 Observability 서비스가 런타임 시 경로를 자동으로 추가합니다. 사용자 정의 Observability 허브 클러스터 URL에 사용하는 중간 구성 요소는 구성 요소가 MTLS 인증을 사용하므로 TLS 종료를 사용할 수 없습니다. 사용자 정의 Alertmanager 허브 클러스터 URL은 기존 인증서 지침을 사용하여 중간 구성 요소 TLS 종료를 지원합니다.

-

customObservabilityHubURL을 사용하는 경우 다음 템플릿을 사용하여 경로 오브젝트를 생성합니다. <intermediate_component_url>을 중간 구성 요소 URL로 바꿉니다.

-

apiVersion: route.openshift.io/v1

kind: Route

metadata:

name: proxy-observatorium-api

namespace: open-cluster-management-observability

spec:

host: <intermediate_component_url>

port:

targetPort: public

tls:

insecureEdgeTerminationPolicy: None

termination: passthrough

to:

kind: Service

name: observability-observatorium-api

weight: 100

wildcardPolicy: None-

customAlertmanagerHubURL을 사용하는 경우 다음 템플릿을 사용하여 경로 오브젝트를 생성합니다. <intermediate_component_url>을 중간 구성 요소 URL로 바꿉니다.

apiVersion: route.openshift.io/v1

kind: Route

metadata:

name: alertmanager-proxy

namespace: open-cluster-management-observability

spec:

host: <intermediate_component_url>

path: /api/v2

port:

targetPort: oauth-proxy

tls:

insecureEdgeTerminationPolicy: Redirect

termination: reencrypt

to:

kind: Service

name: alertmanager

weight: 100

wildcardPolicy: None1.4.13. 세분화된 RBAC 구성 (기술 프리뷰)

클러스터 내의 특정 네임스페이스에 대한 메트릭 액세스를 제한하려면 세분화된 역할 기반 액세스 제어(RBAC)를 사용합니다. 세분화된 RBAC를 사용하면 애플리케이션 팀이 액세스 권한을 부여하는 네임스페이스에 대한 메트릭만 볼 수 있습니다.

해당 허브 클러스터 사용자의 허브 클러스터에서 메트릭 액세스 제어를 구성해야 합니다. 이 허브 클러스터에서 ManagedCluster 사용자 정의 리소스는 모든 관리 클러스터를 나타냅니다. RBAC를 구성하고 허용된 네임스페이스를 선택하려면 ManagedCluster 사용자 정의 리소스에 지정된 규칙 및 작업 동사를 사용합니다.

예를 들어 my-awesome-app 이라는 애플리케이션이 있으며 이 애플리케이션은 devcluster1 및 devcluster2 라는 두 개의 다른 관리 클러스터에 있습니다. 두 클러스터 모두 AwesomeAppNS 네임스페이스에 있습니다. admin 사용자 그룹 my-awesome-app-admins 가 있으며 이 사용자 그룹은 hub 클러스터의 두 네임 스페이스에서만 메트릭에 액세스할 수 있도록 제한하려고 합니다.

이 예제에서는 세분화된 RBAC를 사용하여 사용자 그룹 액세스를 제한하려면 다음 단계를 완료합니다.

메트릭에 액세스할 수 있는 권한으로

ClusterRole리소스를 정의합니다. 리소스는 다음 YAML과 유사할 수 있습니다.apiVersion: rbac.authorization.k8s.io/v1 kind: ClusterRole metadata: name: awesome-app-metrics-role rules: - apiGroups: - "cluster.open-cluster-management.io" resources: - managedclusters:1 resourceNames:2 - devcluster1 - devcluster2 verbs:3 - metrics/AwesomeAppNShuge-app-

metrics-role에 대한ClusterRole리소스를 사용하여my-awesome-app-admins그룹을 바인딩하는ClusterRoleBinding리소스를 정의합니다. 리소스는 다음 YAML과 유사할 수 있습니다.kind: ClusterRoleBinding apiVersion: rbac.authorization.k8s.io/v1 metadata: name: awesome-app-metrics-role-binding subjects: - kind: Group apiGroup: rbac.authorization.k8s.io name: my-awesome-app-admins roleRef: apiGroup: rbac.authorization.k8s.io kind: ClusterRole name: awesome-app-metrics-role

이러한 단계를 완료하면 my-awesome-app-admins 의 사용자가 Grafana 콘솔에 로그인하면 다음과 같은 제한이 있습니다.

- 사용자는 플릿 수준 데이터를 요약하는 대시보드에 대한 데이터를 볼 수 없습니다.

-

사용자는

ClusterRole리소스에 지정된 관리 클러스터 및 네임스페이스만 선택할 수 있습니다.

다양한 유형의 사용자 액세스를 설정하려면 별도의 ClusterRoles 및 ClusterRoleBindings 리소스를 정의하여 네임스페이스의 다른 관리 클러스터를 나타냅니다.

1.4.14. 추가 리소스

- 자세한 내용은 Prometheus 구성 을 참조하십시오. 기록 규칙 및 경고 규칙에 대한 자세한 내용은 Prometheus 문서의 레코딩 규칙 및 경고 규칙을 참조하십시오.

- 대시보드 보기에 대한 자세한 내용은 Grafana 대시보드 사용을 참조하십시오.

- 외부 엔드포인트로 메트릭 내보내기를 참조하십시오.

- 사용자 정의 프로젝트에 대한 모니터링 활성화를 참조하십시오.

- Observability API 를 참조하십시오.

- alertmanager 경로의 인증서를 업데이트하는 방법에 대한 자세한 내용은 alertmanager 에 대한 인증서 교체를 참조하십시오.

- 관찰성 경고에 대한 자세한 내용은 Observability 경고를참조하십시오.

- 경고 전달에 대한 자세한 내용은 Prometheus Alertmanager 설명서 를 참조하십시오.

- 자세한 내용은 Observability 경고를 참조하십시오.

- 관찰 가능성 서비스에 대한 자세한 내용은 Observability 서비스를 참조하십시오.

- 자세한 내용은 Management Workload Partitioning 을 참조하십시오.

1.5. Observability 사용

Observability 서비스를 사용하여 플릿의 클러스터 사용률을 확인합니다.

필수 액세스: 클러스터 관리자

1.5.1. Observability API를 사용하여 메트릭 쿼리

네트워크 연결에서 두 당사자의 ID를 확인하는 상호 TLS를 사용하여 엔드포인트에 액세스하려면 Observability 외부 API를 사용하여 Red Hat OpenShift Container Platform rbac-query-proxy 경로를 통해 메트릭을 쿼리합니다. rbac-query-proxy 경로에 대한 쿼리를 가져오려면 다음 단계를 완료합니다.

다음 명령을 사용하여 경로 세부 정보를 가져옵니다.

oc get route rbac-query-proxy -n open-cluster-management-observabilityOpenShift Container Platform OAuth 액세스 토큰을 사용하여

rbac-query-proxy경로에 액세스하려면 다음 명령을 실행하여 토큰을 가져옵니다. 토큰은 네임스페이스를 가져올 수 있는 권한이 있는 사용자 또는 서비스 계정과 연결되어야 합니다.MY_TOKEN=$(oc whoami --show-token)openshift-ingress경로에 액세스하려면 기본 CA 인증서를 가져오고tls.crt키 콘텐츠를 로컬 파일에 저장합니다. 다음 명령을 실행합니다.oc -n openshift-ingress get secret router-certs-default -o jsonpath="{.data.tls\.crt}" | base64 -d > ca.crt참고: hub 클러스터가 AWS의 OpenShift 서비스에서 실행 중인 경우

router-certs-default시크릿이 존재하지 않습니다. 대신spec.defaultCertificate.name이 기본 수신 컨트롤러 오브젝트를 가리키는 CA 인증서를 사용합니다.tls.crt키의 콘텐츠를 로컬 파일에 저장합니다. 다음 단계를 완료합니다.다음 명령을 실행하여

spec.defaultCertificate.name의 이름을 가져옵니다.SECRET_NAME=$(oc get ingresscontroller default -n openshift-ingress-operator -o jsonpath=" {.spec.defaultCertificate.name}")다음 명령을 실행하여 시크릿에서 인증서를 추출합니다.

oc get secret $SECRET_NAME -n openshift-ingress -o jsonpath=" {.data.tls\.crt}" | base64 -d > ca.crt

API에서 메트릭을 쿼리하려면 다음 명령을 실행합니다.

curl --cacert ./ca.crt -H "Authorization: Bearer {TOKEN}" https://{PROXY_ROUTE_URL}/api/v1/query?query={QUERY_EXPRESSION}참고:

QUERY_EXPRESSION은 표준 Prometheus 쿼리 표현식입니다. 예를 들어 이전 명령의 URL을https://{PROXY_ROUTE_URL}/api/v1/query?query=를 쿼리합니다. 자세한 내용은 Prometheus 쿼리를 참조하십시오.cluster_infrastructure_provider로 교체하여 메트릭 cluster_infrastructure_provider-

rbac-query-proxy경로에 대한 사용자 정의 인증서를 구성하려면 rbac- query-proxy 경로에 대한 인증서 교체를 참조하십시오.

1.5.1.1. 메트릭을 외부 끝점으로 내보내기

Prometheus Remote-Write 사양을 실시간으로 지원하려면 메트릭을 외부 끝점으로 내보냅니다. 메트릭을 외부 끝점으로 내보내려면 다음 단계를 완료합니다.

open-cluster-management-observability네임스페이스에서 외부 끝점의 액세스 정보를 사용하여 외부 끝점에 대한 Kubernetes 시크릿을 생성합니다. 다음 예제 시크릿을 확인합니다.apiVersion: v1 kind: Secret metadata: name: victoriametrics namespace: open-cluster-management-observability type: Opaque stringData: ep.yaml: |1 url: http://victoriametrics:8428/api/v1/write2 http_client_config:3 basic_auth:4 username: test5 password: test6 tls_config:7 secret_name:8 ca_file_key:9 cert_file_key:10 key_file_key:11 insecure_skip_verify:12 - 1

ep.yaml매개변수는 콘텐츠의 키이며 다음 단계의MultiClusterObservability사용자 정의 리소스에서 사용됩니다. 현재 Observability는 기본 인증 또는tls사용을 통해 보안 검사 없이 엔드포인트로 메트릭 내보내기를 지원합니다. 지원되는 매개변수의 전체 목록은 다음 표를 확인하십시오.- 2

url매개변수가 필요하며 외부 끝점의 URL입니다. 값을 문자열로 입력합니다.- 3

http_client_config매개변수는 선택 사항이며 HTTP 클라이언트의 고급 구성입니다.- 4

basic_auth매개변수는 선택 사항이며 기본 인증을 위한 HTTP 클라이언트 구성입니다.- 5

username매개변수는 선택 사항이며 기본 권한 부여의 사용자 이름입니다. 값을 문자열로 입력합니다.- 6

암호는선택 사항이며 기본 권한 부여의 암호입니다. 값을 문자열로 입력합니다.- 7

tls_config매개변수는 선택 사항이며 TLS의 HTTP 클라이언트 구성입니다.- 8

secret_name매개변수는 필수이며 인증서가 포함된 보안의 이름입니다. 값을 문자열로 입력합니다.- 9

ca_file_key매개변수는 필수이며 시크릿의 CA 인증서 키입니다. 이 매개변수는insecure_skip_verify매개변수가true로 설정된 경우에만 선택 사항입니다. 값을 문자열로 입력합니다.- 10

cert_file_key매개변수는 필수이며 시크릿의 클라이언트 인증서 키입니다. 값을 문자열로 입력합니다.- 11

key_file_key매개변수는 필수이며 시크릿의 클라이언트 키입니다. 값을 문자열로 입력합니다.- 12

insecure_skip_verify매개변수는 선택 사항이며 대상 인증서에 대한 확인을 건너뛰는 데 사용됩니다. 부울 값으로 값을 입력합니다.

내보낼 외부 끝점 목록을 추가하려면

MultiClusterObservability사용자 정의 리소스에writeStorage매개변수를 추가합니다. 다음 예제를 확인합니다.spec: storageConfig: writeStorage:1 - key: ep.yaml name: victoriametrics- 1

- 각 항목에는 name 과 key 의 두 가지 속성이 있습니다. name은 엔드포인트 액세스 정보가 포함된 Kubernetes 시크릿의 이름이며 key 는 시크릿에 있는 콘텐츠의 키입니다. 목록에 항목을 두 개 이상 추가하면 메트릭이 여러 외부 엔드포인트로 내보내집니다.

acm_remote_write_requests_total메트릭을 확인하여 메트릭 내보내기를 활성화한 후 지표 내보내기의 상태를 확인합니다.- hub 클러스터의 OpenShift Container Platform 콘솔에서 Observe 섹션에서 Metrics 를 클릭하여 Metrics 페이지로 이동합니다.

-

그런 다음

acm_remote_write_requests_total메트릭을 쿼리합니다. 해당 메트릭의 값은 하나의 관찰자 API 인스턴스에서 하나의 외부 끝점에 대한 특정 응답이 있는 총 요청 수입니다.name레이블은 외부 끝점의 이름입니다.코드레이블은 메트릭 내보내기에 대한 HTTP 요청의 반환 코드입니다.

1.5.2. 대시보드를 사용하여 데이터 보기 및 탐색

hub 클러스터에서 Grafana에 액세스하여 관리 클러스터의 데이터를 확인합니다. 특정 경고를 쿼리하고 쿼리에 대한 필터를 추가할 수 있습니다.

예를 들어 단일 노드 OpenShift 클러스터에서 cluster_infrastructure_provider 경고를 탐색하려면 cluster_infrastructure_provider{clusterType="SNO"}쿼리 표현식을 사용합니다.

참고: 단일 노드 관리 클러스터에서 Observability가 활성화된 경우 ObservabilitySpec.resources.CPU.limits 매개변수를 설정하지 마십시오. CPU 제한을 설정하면 Observability Pod가 관리 클러스터의 용량에 대해 계산됩니다. 추가 리소스 섹션에서 Management Workload Partitioning 에 대한 참조를 참조하십시오.

1.5.2.1. 기록 데이터 보기

기록 데이터를 쿼리할 때 쿼리 매개변수 옵션을 수동으로 설정하여 대시보드에서 표시되는 데이터 양을 제어합니다. 다음 단계를 완료합니다.

- 허브 클러스터에서 콘솔 헤더에 있는 Grafana 링크를 선택합니다.

- 패널 편집을 선택하여 클러스터 대시보드를 편집합니다.

- Grafana의 쿼리 프런트 엔드 데이터 소스에서 쿼리 탭을 클릭합니다.

-

$datasource를 선택합니다. - 더 많은 데이터를 보려면 Step 매개변수 섹션의 값을 늘립니다. Step 매개변수 섹션이 비어 있으면 자동으로 계산됩니다.

-

Custom query parameters 필드를 찾아

max_source_resolution=auto를 선택합니다. - 데이터가 표시되는지 확인하려면 Grafana 페이지를 새로 고칩니다.

쿼리 데이터는 Grafana 대시보드에서 표시됩니다.

1.5.2.2. Red Hat Advanced Cluster Management 대시보드 보기

Red Hat Advanced Cluster Management Observability 서비스를 활성화하면 대시보드 세 개를 사용할 수 있습니다. 다음 대시보드 설명을 확인합니다.

- 경고 분석: 관리 클러스터 플릿 내에서 생성되는 경고의 개요입니다.

- Alert별 클러스터: 경고 이름으로 필터링할 수 있는 경고 대시보드입니다.

- 클러스터별 경고 대시보드: 클러스터별로 필터링하고 클러스터 환경 내에서 시작되거나 보류 중인 경고에 대한 실시간 데이터를 볼 수 있습니다.

1.5.2.3. etcd 테이블 보기

Grafana의 허브 클러스터 대시보드에서 etcd 테이블을 보고 데이터 저장소로 etcd의 안정성을 확인할 수도 있습니다. hub 클러스터에서 Grafana 링크를 선택하여 hub 클러스터에서 수집된 etcd 테이블 데이터를 확인합니다. 관리 클러스터에서 리더 선택 변경 사항이 표시됩니다.

1.5.2.4. Kubernetes API 서버 대시보드 보기

지난 7일 또는 30일 기간 동안 대상 서비스 수준 목표 (SLO) 값을 초과하거나 충족하는 총 클러스터 수를 보려면, 다음 옵션을 사용하여 Kubernetes API 서버 대시보드를 확인합니다.

Grafana의 허브 클러스터 대시보드에서 클러스터 플릿 Kubernetes API 서비스 수준 개요를 확인합니다.

- Grafana 대시보드로 이동합니다.

- Kubernetes > 서비스 수준 개요 > API 서버 를 선택하여 관리 대시보드 메뉴에 액세스합니다. Fleet 개요 및 상위 클러스터 세부 정보가 표시됩니다.

Grafana의 허브 클러스터 대시보드에서 Kubernetes API 서비스 수준 개요 테이블을 보고 지난 7일 또는 30일 동안의 오류 예산, 나머지 다운타임 및 추세를 확인합니다.

- hub 클러스터에서 Grafana 대시보드로 이동합니다.

- Kubernetes > 서비스 수준 개요 > API 서버 를 선택하여 관리 대시보드 메뉴에 액세스합니다. Fleet 개요 및 상위 클러스터 세부 정보가 표시됩니다.

1.5.2.5. OpenShift Virtualization 대시보드 보기

Red Hat OpenShift Virtualization 대시보드를 보고 OpenShift Virtualization Operator가 설치된 각 클러스터에 대한 포괄적인 통찰력을 확인할 수 있습니다. Operator의 상태는 활성 OpenShift Virtualization 경고 및 Hyperconverged Cluster Operator의 조건에 따라 결정됩니다. 또한 각 클러스터에 대해 실행 중인 가상 머신 수와 Operator 버전도 볼 수 있습니다.

또한 대시보드는 Operator의 상태에 영향을 미치는 경고를 나열하고 Operator의 상태에 영향을 미치지 않는 경우에도 모든 OpenShift Virtualization 경고를 별도로 포함합니다. 클러스터 이름, Operator 상태 경고, 경고의 상태 영향 및 경고 심각도별로 대시보드를 필터링할 수 있습니다.

1.5.3. 추가 리소스

- 자세한 내용은 Prometheus Remote-Write 사양을 참조하십시오.

- 사용자 소유 OAuth 액세스 토큰 관리를 참조하십시오.

- Observability 서비스 활성화를 읽습니다.

- 자세한 내용은 Observability 서비스를 참조하십시오.

1.5.4. Grafana 대시보드 사용

Grafana 대시보드를 사용하여 허브 클러스터 및 관리 클러스터 지표를 확인합니다. Grafana 경고 대시보드에 표시되는 데이터는 관리 클러스터에서 발생하는 경고 메트릭을 사용합니다. 경고 메트릭은 hub 클러스터의 Red Hat Advanced Cluster Management 경고 관리자에게 경고를 전달하는 관리 클러스터에 영향을 미치지 않습니다. 따라서 지표 및 경고에는 별도의 전파 메커니즘이 있으며 별도의 코드 경로를 따릅니다.

Grafana 경고 대시보드에 데이터가 표시되면 관리 클러스터 경고가 Red Hat Advanced Cluster Management Hub 클러스터 경고 관리자로 성공적으로 전달된다고 보장하지 않습니다. 메트릭이 관리 클러스터에서 전파되는 경우 Grafana 경고 대시보드에 표시된 데이터를 볼 수 있습니다.

개발 요구에 Grafana 대시보드를 사용하려면 다음을 완료합니다.

1.5.4.1. Grafana 개발자 인스턴스 설정

grafana-dev 인스턴스를 생성하여 Grafana 대시보드를 설계할 수 있습니다. 최신 grafana-dev 인스턴스를 사용해야 합니다.

Grafana 개발자 인스턴스를 설정하려면 다음 단계를 완료합니다.

-

툴폴더에 있는 스크립트를 실행할 수 있도록open-cluster-management/multicluster-observability-operator/리포지토리를 복제합니다. setup-grafana-dev.sh를 실행하여 Grafana 인스턴스를 설정합니다. 스크립트를 실행하면secret/grafana-dev-config,deployment.apps/grafana-dev,service/grafana-dev,ingress.extensions/grafana-dev,persistentvolumeclaim/grafana-dev:./setup-grafana-dev.sh --deploy secret/grafana-dev-config created deployment.apps/grafana-dev created service/grafana-dev created serviceaccount/grafana-dev created clusterrolebinding.rbac.authorization.k8s.io/open-cluster-management:grafana-crb-dev created route.route.openshift.io/grafana-dev created persistentvolumeclaim/grafana-dev created oauthclient.oauth.openshift.io/grafana-proxy-client-dev created deployment.apps/grafana-dev patched service/grafana-dev patched route.route.openshift.io/grafana-dev patched oauthclient.oauth.openshift.io/grafana-proxy-client-dev patched clusterrolebinding.rbac.authorization.k8s.io/open-cluster-management:grafana-crb-dev patchedswitch-to-grafana-admin.sh스크립트를 사용하여 사용자 역할을 Grafana 관리자로 전환합니다.-

Grafana URL,

https:grafana-dev-open-cluster-management-observability.{OPENSHIFT_INGRESS_DOMAIN}을 선택하고 로그인합니다. 그런 다음 다음 명령을 실행하여 전환된 사용자를 Grafana 관리자로 추가합니다. 예를 들어

kubeadmin을 사용하여 로그인한 후 다음 명령을 실행합니다../switch-to-grafana-admin.sh kube:admin User <kube:admin> switched to be grafana admin

-

Grafana URL,

Grafana 개발자 인스턴스가 설정됩니다.

1.5.4.1.1. Grafana 버전 확인

CLI(명령줄 인터페이스) 또는 Grafana 사용자 인터페이스에서 Grafana 버전을 확인합니다.

hub 클러스터에 로그인한 후 observabilty-grafana Pod 터미널에 액세스합니다. 다음 명령을 실행합니다.

grafana-cli현재 클러스터 환경 내에 배포된 Grafana 버전이 표시됩니다.

또는 Grafana 대시보드에서 Manage (관리) 탭으로 이동할 수 있습니다. 버전이 나열된 페이지 끝으로 스크롤합니다.

1.5.4.2. Grafana 대시보드 설계

Grafana 인스턴스를 설정한 후 대시보드를 설계할 수 있습니다. Grafana 콘솔을 새로 고치고 대시보드를 설계하려면 다음 단계를 완료합니다.

- Grafana 콘솔에서 탐색 패널에서 Create 아이콘을 선택하여 대시보드를 만듭니다. 대시보드 를 선택한 다음 새 패널 추가 를 클릭합니다.

- 새 대시보드/편집 패널 에서 쿼리 탭으로 이동합니다.

-

데이터 소스 선택기에서

Observatorium을 선택하고 PromQL 쿼리를 입력하여 쿼리를 구성합니다. - Grafana 대시보드 헤더에서 대시보드 헤더에 있는 저장 아이콘을 클릭합니다.

- 설명이 포함된 이름을 추가하고 저장을 클릭합니다.

1.5.4.2.1. ConfigMap을 사용하여 Grafana 대시보드 설계

ConfigMap을 사용하여 Grafana 대시보드를 설계합니다. generate-dashboard-configmap-yaml.sh 스크립트를 사용하여 대시보드 ConfigMap을 생성하고 ConfigMap을 로컬에 저장할 수 있습니다.

./generate-dashboard-configmap-yaml.sh "Your Dashboard Name"

Save dashboard <your-dashboard-name> to ./your-dashboard-name.yaml이전에 언급한 스크립트를 실행할 수 있는 권한이 없는 경우 다음 단계를 완료합니다.

- 대시보드를 선택하고 대시보드 설정 아이콘을 클릭합니다.

- 탐색 패널에서 JSON 모델 아이콘을 클릭합니다.

-

대시보드 JSON 데이터를 복사하여

data섹션에 붙여넣습니다. 이름을수정하고$your-dashboard-name을 바꿉니다.data.$your-dashboard-name.json.$your_dashboard_json .json의uid필드에 UUID(Universally unique identifier)를 입력합니다. uuidegen 과 같은 프로그램을 사용하여 UUID를 생성할 수 있습니다. ConfigMap은 다음 파일과 유사할 수 있습니다.kind: ConfigMap apiVersion: v1 metadata: name: $your-dashboard-name namespace: open-cluster-management-observability labels: grafana-custom-dashboard: "true" data: $your-dashboard-name.json: |- $your_dashboard_json참고:

대시보드가

grafana-dev인스턴스 내에 생성되는 경우 대시보드 이름을 가져와서 스크립트에서 인수로 전달할 수 있습니다. 예를 들어 Demo Dashboard 라는 대시보드는grafana-dev인스턴스에 생성됩니다. CLI에서 다음 스크립트를 실행할 수 있습니다../generate-dashboard-configmap-yaml.sh "Demo Dashboard"스크립트를 실행한 후 다음 메시지가 표시될 수 있습니다.

Save dashboard <demo-dashboard> to ./demo-dashboard.yaml대시보드가 일반 폴더에 없는 경우 이 ConfigMap의

annotations섹션에 폴더 이름을 지정할 수 있습니다.annotations: observability.open-cluster-management.io/dashboard-folder: CustomConfigMap에 대한 업데이트를 완료한 후 이를 설치하여 대시보드를 Grafana 인스턴스로 가져올 수 있습니다.

CLI 또는 OpenShift Container Platform 콘솔에서 YAML을 적용하여 YAML 파일이 생성되었는지 확인합니다. open-cluster-management-observability 네임스페이스 내의 ConfigMap이 생성됩니다. CLI에서 다음 명령을 실행합니다.

oc apply -f demo-dashboard.yaml

OpenShift Container Platform 콘솔에서 demo-dashboard.yaml 파일을 사용하여 ConfigMap을 생성합니다. 대시보드는 사용자 지정 폴더에 있습니다.

1.5.4.3. Grafana 개발자 인스턴스 설치 제거

인스턴스를 제거하면 관련 리소스도 삭제됩니다. 다음 명령을 실행합니다.

./setup-grafana-dev.sh --clean

secret "grafana-dev-config" deleted

deployment.apps "grafana-dev" deleted

serviceaccount "grafana-dev" deleted

route.route.openshift.io "grafana-dev" deleted

persistentvolumeclaim "grafana-dev" deleted

oauthclient.oauth.openshift.io "grafana-proxy-client-dev" deleted

clusterrolebinding.rbac.authorization.k8s.io "open-cluster-management:grafana-crb-dev" deleted1.5.4.4. 추가 리소스

- 외부 엔드포인트로 메트릭 내보내기를 참조하십시오.

- UUID를 생성하는 방법은 uuidegen 을 참조하십시오.

- 자세한 내용은 Grafana에서 관리되는 클러스터 레이블 사용을 참조하십시오.

- Grafana 대시보드를 사용하여 페이지 시작 부분으로 돌아갑니다.

- 자세한 내용은 Observing 환경 소개 를 참조하십시오.

1.5.5. Grafana에서 관리되는 클러스터 레이블 사용

관리 클러스터 레이블을 활성화하여 Grafana 대시보드와 함께 사용합니다. hub 클러스터에서 관찰 기능이 활성화되면 open-cluster-management-observability 네임스페이스에 observability-managed-cluster-label-allowlist ConfigMap이 생성됩니다. ConfigMap에는 ACM - Cluster Overview Grafana 대시보드 내에서 필터링할 레이블 이름 목록을 채울 observabilty-rbac-query-proxy Pod에서 관리하는 관리 클러스터 레이블 목록이 포함되어 있습니다. 기본적으로 관찰 기능은 observability-managed-cluster-label-allowlist ConfigMap의 레이블 서브 세트를 무시합니다.

클러스터를 관리형 클러스터 플릿 또는 수정으로 가져올 때 observability-rbac-query-proxy Pod는 관리 클러스터 라벨에 대한 참조의 변경 사항을 감시하고 변경 사항을 반영하도록 observability-managed-cluster-label-allowlist ConfigMap을 자동으로 업데이트합니다. ConfigMap에는 ignore_ 또는 레이블 목록에 포함된 고유한 레이블 이름만 포함됩니다. labels observability-managed-cluster-label-allowlist ConfigMap은 다음 YAML 파일과 유사할 수 있습니다.

data:

managed_cluster.yaml: |

ignore_labels:

- clusterID

- cluster.open-cluster-management.io/clusterset

- feature.open-cluster-management.io/addon-application-manager

- feature.open-cluster-management.io/addon-cert-policy-controller

- feature.open-cluster-management.io/addon-cluster-proxy

- feature.open-cluster-management.io/addon-config-policy-controller

- feature.open-cluster-management.io/addon-governance-policy-framework

- feature.open-cluster-management.io/addon-iam-policy-controller

- feature.open-cluster-management.io/addon-observability-controller

- feature.open-cluster-management.io/addon-search-collector

- feature.open-cluster-management.io/addon-work-manager

- installer.name

- installer.namespace

- local-cluster

- name

labels:

- cloud

- vendor

+ <1> ConfigMap의 ignore_labels 키 목록에 나열된 모든 레이블은 ACM - Clusters Overview Grafana 대시보드의 드롭다운 필터에서 제거됩니다. <2> 활성화된 레이블은 ACM - Clusters Overview Grafana 대시보드의 드롭다운 필터에 표시됩니다. 선택한 레이블 키 값에 따라 값을 acm_managed_cluster_labels 지표에서 가져옵니다.

Grafana에서 관리 클러스터 레이블을 사용하는 방법을 계속 읽습니다.

1.5.5.1. 관리형 클러스터 레이블 추가

observability-managed-cluster-label-allowlist ConfigMap에 관리 클러스터 레이블을 추가하면 Grafana에서 라벨을 필터 옵션으로 사용할 수 있습니다. 허브 클러스터 또는 관리 클러스터 플릿과 연결된 관리형 클러스터 오브젝트에 고유한 레이블을 추가합니다. 예를 들어 레이블 department=finance 를 관리 클러스터에 추가하면 ConfigMap이 업데이트되어 다음 변경 사항과 유사할 수 있습니다.

data:

managed_cluster.yaml: |

ignore_labels:

- clusterID

- cluster.open-cluster-management.io/clusterset

- feature.open-cluster-management.io/addon-application-manager

- feature.open-cluster-management.io/addon-cert-policy-controller

- feature.open-cluster-management.io/addon-cluster-proxy

- feature.open-cluster-management.io/addon-config-policy-controller

- feature.open-cluster-management.io/addon-governance-policy-framework

- feature.open-cluster-management.io/addon-iam-policy-controller

- feature.open-cluster-management.io/addon-observability-controller

- feature.open-cluster-management.io/addon-search-collector

- feature.open-cluster-management.io/addon-work-manager

- installer.name

- installer.namespace

- local-cluster

- name

labels:

- cloud

- department

- vendor1.5.5.2. 관리형 클러스터 라벨 활성화

observability-managed-cluster-label-allowlist ConfigMap의 ignore_labels 목록에서 레이블을 제거하여 이미 비활성화된 관리형 클러스터 레이블을 활성화합니다.

예를 들어 local-cluster 및 name 레이블을 활성화합니다. observability-managed-cluster-label-allowlist ConfigMap은 다음 콘텐츠와 유사할 수 있습니다.

data:

managed_cluster.yaml: |

ignore_labels:

- clusterID

- installer.name

- installer.namespace

labels:

- cloud

- vendor

- local-cluster

- name

ConfigMap이 30초 후에 다시 동기화되어 클러스터 라벨이 업데이트되었는지 확인합니다. ConfigMap을 업데이트한 후 open-cluster-management-observability 네임스페이스에서 observability-rbac-query-proxy Pod 로그를 확인하여 라벨이 나열된 위치를 확인합니다. Pod 로그에 다음 정보가 표시될 수 있습니다.

enabled managedcluster labels: <label>Grafana 대시보드에서 레이블이 Label 드롭다운 메뉴에 값으로 나열되어 있는지 확인합니다.

1.5.5.3. 관리형 클러스터 레이블 비활성화

Label 드롭다운 필터에 관리 클러스터 레이블이 나열되지 않도록 제외합니다. ignore_labels 목록에 레이블 이름을 추가합니다. 예를 들어 local-cluster 및 name 을 ignore_labels 목록에 다시 추가하는 경우 YAML은 다음 파일과 유사할 수 있습니다.

data:

managed_cluster.yaml: |

ignore_labels:

- clusterID

- installer.name

- installer.namespace

- local-cluster

- name

labels:

- cloud

- vendor

open-cluster-management-observability 네임스페이스에서 observability-rbac-query-proxy Pod 로그를 확인하여 라벨이 나열된 위치를 확인합니다. Pod 로그에 다음 정보가 표시될 수 있습니다.

disabled managedcluster label: <label>1.5.5.4. 추가 리소스

- Grafana 대시보드 사용을 참조하십시오.

- Grafana에서 관리 클러스터 레이블을 사용하여 페이지 시작 부분으로 돌아갑니다.

1.6. 경고 관리

hub 클러스터 및 관리 클러스터 변경에 대한 알림을 받을 관찰 기능 서비스에 대한 경고를 수신하고 정의합니다.

1.6.1. 사전 요구 사항

- 허브 클러스터에서 관찰 기능을 활성화해야 합니다.

-

open-cluster-management-observability네임스페이스에 시크릿 리소스에 대한 생성 권한이 있어야 합니다. -

MultiClusterObservability리소스에 대한 편집 권한이 있어야 합니다.

1.6.2. Alertmanager 구성

이메일, Slack, PagerDuty와 같은 외부 메시징 도구를 통합하여 Alertmanager에서 알림을 수신합니다. 통합을 추가하려면 open-cluster-management-observability 네임스페이스에서 alertmanager-config 시크릿을 재정의하고 Alertmanager의 경로를 구성해야 합니다. 사용자 정의 수신자 규칙을 업데이트하려면 다음 단계를 완료합니다.

alertmanager-config시크릿에서 데이터를 추출합니다. 다음 명령을 실행합니다.oc -n open-cluster-management-observability get secret alertmanager-config --template='{{ index .data "alertmanager.yaml" }}' |base64 -d > alertmanager.yaml다음 명령을 실행하여

alertmanager.yaml파일 구성을 편집하고 저장합니다.oc -n open-cluster-management-observability create secret generic alertmanager-config --from-file=alertmanager.yaml --dry-run -o=yaml | oc -n open-cluster-management-observability replace secret --filename=-업데이트된 시크릿은 다음 콘텐츠와 유사할 수 있습니다.

global smtp_smarthost: 'localhost:25' smtp_from: 'alertmanager@example.org' smtp_auth_username: 'alertmanager' smtp_auth_password: 'password' templates: - '/etc/alertmanager/template/*.tmpl' route: group_by: ['alertname', 'cluster', 'service'] group_wait: 30s group_interval: 5m repeat_interval: 3h receiver: team-X-mails routes: - match_re: service: ^(foo1|foo2|baz)$ receiver: team-X-mails

변경 사항이 수정 후 즉시 적용됩니다. Alertmanager의 예는 prometheus/alertmanager 를 참조하십시오.

1.6.2.1. Alertmanager Pod 내에서 보안 마운트

권한 부여 인증 정보에 액세스하기 위해 alertmanager Pod 내에 마운트할 수 있는 임의의 콘텐츠로 Secret 리소스를 생성할 수 있습니다.

Alertmanager 구성 내에서 시크릿을 참조하려면 open-cluster-management-observability 네임스페이스에 Secret 리소스 콘텐츠를 추가하고 해당 콘텐츠를 alertmanager Pod에 마운트합니다. 예를 들어 tls 시크릿을 생성하고 마운트하려면 다음 단계를 완료합니다.

TLS 인증서를 사용하여

tls보안을 생성하려면 다음 명령을 실행합니다.oc create secret tls tls --cert=</path/to/cert.crt> --key=</path/to/cert.key> -n open-cluster-management-observabilitytls시크릿을MultiClusterObservability리소스에 마운트하려면고급섹션에 추가합니다. 리소스는 다음 콘텐츠와 유사할 수 있습니다.... advanced: alertmanager: secrets: ['tls']Alertmanager 설정 내에

tls시크릿 참조를 추가하려면 구성에 시크릿 경로를 추가합니다. 리소스는 다음 구성과 유사할 수 있습니다.tls_config: cert_file: '/etc/alertmanager/secrets/tls/tls.crt' key_file: '/etc/alertmanager/secrets/tls/tls.key'보안이

alertmanagerpod 내에 있는지 확인하려면 다음 명령을 실행합니다.oc -n open-cluster-management-observability get secret alertmanager-config --template='{{ index .data "alertmanager.yaml" }}' |base64 -d > alertmanager.yamlYAML은 다음 내용과 유사할 수 있습니다.

"global": "http_config": "tls_config": "cert_file": "/etc/alertmanager/secrets/storyverify/tls.crt" "key_file": "/etc/alertmanager/secrets/storyverify/tls.key"alertmanager.yaml구성을alertmanager-config시크릿에 저장하려면 다음 명령을 실행합니다.oc -n open-cluster-management-observability create secret generic alertmanager-config --from-file=alertmanager.yaml --dry-run -o=yaml이전 보안을 새 보안으로 교체하려면 다음 명령을 실행합니다.

oc -n open-cluster-management-observability replace secret --filename=-

1.6.3. 경고 전달

관찰 기능을 활성화하면 OpenShift Container Platform 관리 클러스터의 경고가 허브 클러스터로 자동으로 전송됩니다. alertmanager-config YAML 파일을 사용하여 외부 알림 시스템으로 경고를 구성할 수 있습니다.

alertmanager-config YAML 파일의 다음 예제를 확인합니다.

global:

slack_api_url: '<slack_webhook_url>'

route:

receiver: 'slack-notifications'

group_by: [alertname, datacenter, app]

receivers:

- name: 'slack-notifications'

slack_configs:

- channel: '#alerts'

text: 'https://internal.myorg.net/wiki/alerts/{{ .GroupLabels.app }}/{{ .GroupLabels.alertname }}'

경고 전달을 위해 프록시를 구성하려면 다음 글로벌 항목을 alertmanager-config YAML 파일에 추가합니다.

global:

slack_api_url: '<slack_webhook_url>'

http_config:

proxy_url: http://****1.6.3.1. 관리 클러스터에 대한 경고 전달 비활성화

관리 클러스터에 대한 경고 전달을 비활성화하려면 MultiClusterObservability 사용자 정의 리소스에 다음 주석을 추가합니다.

metadata:

annotations:

mco-disable-alerting: "true"

주석을 설정하면 관리 클러스터에서 경고 전달 구성이 복원됩니다. openshift-monitoring 네임스페이스의 ocp-monitoring-config 구성 맵에 대한 변경 사항도 복원됩니다. 주석을 설정하면 ocp-monitoring-config 구성 맵이 더 이상 observability Operator 끝점에 의해 관리되거나 업데이트되지 않습니다. 구성을 업데이트하면 관리형 클러스터의 Prometheus 인스턴스가 다시 시작됩니다.

중요: 메트릭에 영구 볼륨이 있는 Prometheus 인스턴스가 있고 Prometheus 인스턴스가 다시 시작되면 관리 클러스터의 지표가 손실됩니다. hub 클러스터의 메트릭은 영향을 받지 않습니다.

변경 사항을 되돌리면 open-cluster-management-addon-observability 네임스페이스에 cluster-monitoring-reverted 라는 ConfigMap이 생성됩니다. ConfigMap에서 수동으로 추가한 새 경고 전달 구성이 복원되지 않습니다.

허브 클러스터 경고 관리자가 더 이상 관리된 클러스터 경고를 타사 메시징 툴에 전파하지 않는지 확인합니다. 이전 섹션, Alertmanager 구성 을 참조하십시오.

1.6.4. 음소거 경고

수신하지 않으려는 경고를 추가합니다. 경고 이름, 일치 레이블 또는 시간 기간으로 경고를 음소거할 수 있습니다. 음소거하려는 경고를 추가하면 ID가 생성됩니다. 음소거 경고의 ID는 d839aca9-ed46-40be-84c4-dca8773671da 문자열과 유사할 수 있습니다.

경고를 음소거하는 방법에 대해 계속 읽습니다.

Red Hat Advanced Cluster Management 경고를 음소거하려면

open-cluster-management-observability네임스페이스의alertmanagerPod에 액세스할 수 있어야 합니다. 예를 들어observability-alertmanager-0Pod 터미널에 다음 명령을 입력하여 silenceSampleAlert:amtool silence add --alertmanager.url="http://localhost:9093" --author="user" --comment="Silencing sample alert" alertname="SampleAlert"여러 일치 레이블을 사용하여 경고를 음소거합니다. 다음 명령은

match-label-1및match-label-2를 사용합니다.amtool silence add --alertmanager.url="http://localhost:9093" --author="user" --comment="Silencing sample alert" <match-label-1>=<match-value-1> <match-label-2>=<match-value-2>특정 기간 동안 경고를 음소거하려면

--duration플래그를 사용합니다. 다음 명령을 실행하여SampleAlert를 1시간 동안 음소거합니다.amtool silence add --alertmanager.url="http://localhost:9093" --author="user" --comment="Silencing sample alert" --duration="1h" alertname="SampleAlert"음소거된 경고의 시작 또는 종료 시간을 지정할 수도 있습니다. 다음 명령을 입력하여 특정 시작 시

SampleAlert를 음소거합니다.amtool silence add --alertmanager.url="http://localhost:9093" --author="user" --comment="Silencing sample alert" --start="2023-04-14T15:04:05-07:00" alertname="SampleAlert"생성된 모든 음소거 경고를 보려면 다음 명령을 실행합니다.

amtool silence --alertmanager.url="http://localhost:9093"더 이상 경고를 음소거하지 않으려면 다음 명령을 실행하여 경고의 실칭을 종료합니다.

amtool silence expire --alertmanager.url="http://localhost:9093" "d839aca9-ed46-40be-84c4-dca8773671da"모든 경고의 silencing을 종료하려면 다음 명령을 실행합니다.

amtool silence expire --alertmanager.url="http://localhost:9093" $(amtool silence query --alertmanager.url="http://localhost:9093" -q)

1.6.4.1. 관찰성 스토리지 마이그레이션

경고 음소거를 사용하는 경우 음소거를 이전 상태에서 유지하면서 관찰 기능을 마이그레이션할 수 있습니다. 이렇게 하려면 선택한 StorageClass 리소스를 사용하는 새 StatefulSets 및 PersistentVolumes (PV) 리소스를 생성하여 Red Hat Advanced Cluster Management observability 스토리지를 마이그레이션합니다.

참고: PV의 스토리지는 클러스터에서 수집된 지표를 저장하는 데 사용되는 오브젝트 스토리지와 다릅니다.

StatefulSets 및 PV를 사용하여 관찰 기능 데이터를 새 스토리지로 마이그레이션하는 경우 다음 데이터 구성 요소가 저장됩니다.

- Observatorium 또는 Thanos: 데이터를 수신한 다음 오브젝트 스토리지에 업로드합니다. 일부 구성 요소는 PV에 데이터를 저장합니다. 이 데이터의 경우 Observatorium 또는 Thanos는 시작 시 오브젝트 스토리지를 자동으로 다시 생성하므로 이 데이터를 손실해도 결과가 발생하지 않습니다.

- Alertmanager: 음소거된 경고만 저장합니다. 이러한 음소거된 경고를 유지하려면 해당 데이터를 새 PV로 마이그레이션해야 합니다.

관찰성 스토리지를 마이그레이션하려면 다음 단계를 완료합니다.

-

MultiClusterObservability에서.spec.storageConfig.storageClass필드를 새 스토리지 클래스로 설정합니다. -

PersistentVolumeClaim을 삭제할 때에도 이전PersistentVolumes의 데이터를 유지하려면 기존의 모든PersistentVolumes로 이동합니다. -

reclaimPolicy를"Retain": 'oc patch pv <your-pv-name> -p '{"spec":{"persistentVolumeReclaimPolicy":"Retain"}}'로 변경합니다. - 선택 사항: 데이터 손실을 방지하려면 OCP 4의 DG 8 Operator의 다른 스토리지 클래스로 영구 데이터 마이그레이션 을 참조하십시오.

다음 StatefulSet 사례에서

StatefulSetPersistentVolumeClaim을 둘 다 삭제합니다.-

alertmanager-db-observability-alertmanager-<REPLICA_NUMBER> -

data-observability-thanos-<COMPONENT_NAME> -

data-observability-thanos-receive-default -

data-observability-thanos-store-shard -

중요: 새

StatefulSet을 생성할 수 있도록MultiClusterObservabilityOperator Pod를 삭제한 후 다시 생성해야 할 수 있습니다.

-

-

이름이 동일하지만 올바른

StorageClass를 사용하여 새PersistentVolumeClaim을 다시 생성합니다. -

이전

PersistentVolume을 참조하는 새PersistentVolumeClaim을 생성합니다. -

새

StatefulSet및PersistentVolumes에서 선택한 새StorageClass를 사용하는지 확인합니다.

1.6.5. 경고 비활성화

전 세계적으로 클러스터 전체에서 Red Hat Advanced Cluster Management 경고를 표시하지 않도록 합니다. open-cluster-management-observability 네임스페이스에서 alertmanager-config 에서 억제 규칙을 정의하여 경고를 비활성화합니다.

억제 규칙은 기존의 다른 일치 항목 집합과 일치하는 매개 변수 집합이 있는 경우 경고를 음소거합니다. 규칙을 적용하려면 대상 및 소스 경고 모두 동일한 목록의 라벨 이름에 대해 동일한 레이블 값이 있어야 합니다. inhibit_rules 는 다음과 유사할 수 있습니다.

global:

resolve_timeout: 1h

inhibit_rules:

- equal:

- namespace

source_match:

severity: critical

target_match_re:

severity: warning|info- 1 1

inhibit_rules매개 변수 섹션은 동일한 네임스페이스에서 경고를 찾도록 정의됩니다. 네임스페이스 내에서 위험 경고가 시작되고 해당 네임스페이스에 심각도 수준 경고 또는정보가포함된 기타경고가있는 경우중요한경고만 Alertmanager 수신자로 라우팅됩니다.일치하는 경우 다음 경고가 표시될 수 있습니다.ALERTS{alertname="foo", namespace="ns-1", severity="critical"} ALERTS{alertname="foo", namespace="ns-1", severity="warning"}- 2 2

source_match및target_match_re매개변수의 값이 일치하지 않으면 경고가 수신자로 라우팅됩니다.ALERTS{alertname="foo", namespace="ns-1", severity="critical"} ALERTS{alertname="foo", namespace="ns-2", severity="warning"}- Red Hat Advanced Cluster Management에서 억제된 경고를 보려면 다음 명령을 입력합니다.

amtool alert --alertmanager.url="http://localhost:9093" --inhibited

1.6.6. 추가 리소스

- 자세한 내용은 관찰 기능 사용자 지정을 참조하십시오.

- 자세한 관찰 기능 항목은 Observability 서비스를 참조하십시오.

2장. Red Hat Insights에서 관찰 기능 사용

Red Hat Insights는 Red Hat Advanced Cluster Management 관찰 기능과 통합되어 있으며 클러스터의 기존 또는 잠재적인 문제를 식별하는 데 도움이 됩니다. Red Hat Insights는 안정성, 성능, 네트워크 및 보안 위험을 식별, 우선 순위 및 해결하는 데 도움이 됩니다. Red Hat OpenShift Container Platform은 OpenShift Cluster Manager를 통해 클러스터 상태 모니터링을 제공합니다. OpenShift Cluster Manager는 클러스터의 상태, 사용량 및 크기에 대한 익명화되고 집계된 정보를 수집합니다. 자세한 내용은 Red Hat Insights 제품 설명서를 참조하십시오.

OpenShift 클러스터를 생성하거나 가져올 때 관리형 클러스터에서 익명화된 데이터가 Red Hat으로 자동 전송됩니다. 이 정보는 클러스터 상태 정보를 제공하는 인사이트를 생성하는 데 사용됩니다. Red Hat Advanced Cluster Management 관리자는 이 상태 정보를 사용하여 심각도에 따라 경고를 생성할 수 있습니다.

필수 액세스: 클러스터 관리자

2.1. 사전 요구 사항

- Red Hat Insights가 활성화되어 있는지 확인합니다. 자세한 내용은 원격 상태 보고를 비활성화하려면 글로벌 클러스터 풀 시크릿 수정을 참조하십시오.

- OpenShift Container Platform 버전 4.0 이상을 설치합니다.

- OpenShift Cluster Manager에 등록된 Hub 클러스터 사용자는 OpenShift Cluster Manager의 모든 Red Hat Advanced Cluster Management 관리 클러스터를 관리할 수 있어야 합니다.

2.2. 인사이트 정책 보고서관리

Red Hat Advanced Cluster Management for Kubernetes PolicyReports 는 insights-client 가 생성한 위반입니다. PolicyReports 는 인시던트 관리 시스템으로 전송되는 경고를 정의하고 구성하는 데 사용됩니다. 위반이 발생하면 PolicyReport 의 경고가 인시던트 관리 시스템으로 전송됩니다.

2.2.1. 인사이트 정책 보고서 검색

관리 클러스터에서 위반이 있는 특정 Insights PolicyReport 를 검색할 수 있습니다. 다음 단계를 완료합니다.

- Red Hat Advanced Cluster Management Hub 클러스터에 로그인합니다.

- 탐색 메뉴에서 Search 를 선택합니다.

kind:PolicyReport라는 쿼리를 입력합니다.참고:

PolicyReport이름은 클러스터 이름과 일치합니다.-

Insights 정책 위반 및 카테고리를 사용하여 쿼리를 지정할 수 있습니다.

PolicyReport이름을 선택하면 연결된 클러스터의 세부 정보 페이지로 리디렉션됩니다. Insights 사이드바가 자동으로 표시됩니다. 검색 서비스가 비활성화되고 인사이트를 검색하려면 hub 클러스터에서 다음 명령을 실행합니다.

oc get policyreport --all-namespaces

2.2.2. 콘솔에서 확인된 문제 보기

특정 클러스터에서 확인된 문제를 볼 수 있습니다. 다음 단계를 완료합니다.

- Red Hat Advanced Cluster Management 클러스터에 로그인합니다.

- 탐색 메뉴에서 개요 를 선택합니다.

-

클러스터 문제 요약 카드를 확인합니다. 심각도 링크를 선택하여 해당 심각도와 연결된

PolicyReports를 확인합니다. 클러스터 문제 및 심각도에 대한 세부 정보는 검색 페이지에서 표시됩니다. 정책은 심각도와 연결되어 있고 하나 이상의 문제가 나타납니다. - 클러스터 페이지에서 클러스터 세부 정보를 보려면 정책 보고서를 선택합니다. 상태 카드에 는 노드 , 애플리케이션 ,정책 위반 및 확인된 문제에 대한 정보가 표시됩니다.

세부 정보를 보려면 식별된 문제 수를 선택합니다. 확인된 문제 카드는 Red Hat Insights의 정보를 나타냅니다. 확인된 문제 상태에는 심각도별 문제 수가 표시됩니다. 문제에 사용되는 분류 수준은 심각,주요,낮음 및 경고 와 같은 심각도 범주입니다.

- 또는 탐색 메뉴에서 클러스터를 선택할 수 있습니다.

- 자세한 내용을 보려면 표에서 관리 클러스터를 선택합니다.

- 상태 카드에서 확인된 문제 수를 확인합니다.

- 잠재적인 문제 수를 선택하여 잠재적 문제 패널에서 문제에 대한 심각도 차트 및 권장 수정 사항을 확인합니다. 검색 기능을 사용하여 권장 수정 사항을 검색할 수도 있습니다. 수정 옵션은 취약점에 대한 설명, 취약점이 연결된 카테고리 및 총 위험 요소를 표시합니다.

취약점의 링크를 클릭하여 해결 방법 및 취약점 의 이유를 확인합니다.

참고: 문제를 해결할 때 30분마다 Red Hat Insights가 제공되며 2시간마다 Red Hat Insights가 업데이트됩니다.

PolicyReport에서 경고 메시지를 보낸 구성 요소가 있는지 확인하십시오.-

Governance 페이지로 이동하여 특정

PolicyReport를 선택합니다. -

Status 탭을 선택하고 세부 정보 보기를 클릭하여

PolicyReportYAML 파일을 확인합니다. -

위반을 보낸 구성 요소를 알려주는

source매개 변수를 찾습니다. value 옵션은grc및insights입니다.

-

Governance 페이지로 이동하여 특정

2.2.3. 업데이트 위험 예측 보기

관리 클러스터를 업데이트할 때 발생할 수 있는 위험을 확인합니다. 다음 단계를 완료합니다.

- 관리 클러스터에 로그인합니다.

- 개요 페이지로 이동합니다.

- Insights의 Powered by Insights 섹션에서 심각도별로 나열된 예상 위험이 있는 클러스터의 백분율을 볼 수 있습니다.

- 클러스터 페이지에서 클러스터 목록을 볼 심각도 수를 선택합니다.

- 원하는 클러스터를 선택한 다음 작업 드롭다운 버튼을 클릭합니다.

- 클러스터 업그레이드 를 클릭하여 upgdate 위험을 확인합니다.

- Upgrade clusters modal에서 Upgrade risk 열을 찾아 Hybrid Cloud 콘솔에서 정보를 볼 수 있는 위험 수에 대한 링크를 클릭합니다.

2.3. 추가 리소스

-

PolicyReports에 대한 사용자 정의 경고 규칙을 만드는 방법을 알아보려면 자세한 내용은 Alertmanager 구성을 참조하십시오. - Observability 서비스를 참조하십시오.