가상화 구성 및 관리

호스트 설정, 가상 머신 생성 및 관리, 가상화 기능 이해

초록

- 가상화의 기능 및 사용 사례

- 명령줄 유틸리티를 사용하여 호스트 및 가상 머신을 관리하는 방법과 웹 콘솔을 사용하는 방법

- Intel 64, AMD64 및 IBM Z와 같은 다양한 시스템 아키텍처에 가상화의 지원 제한 사항

Red Hat 문서에 관한 피드백 제공

문서 개선을 위한 의견에 감사드립니다. 어떻게 개선할 수 있는지 알려주십시오.

Jira를 통해 피드백 제출 (계정 필요)

- Jira 웹 사이트에 로그인합니다.

- 상단 탐색 바에서 생성을 클릭합니다.

- 요약 필드에 설명 제목을 입력합니다.

- 설명 필드에 개선을 위한 제안을 입력합니다. 문서의 관련 부분에 대한 링크를 포함합니다.

- 대화 상자 하단에서 생성 을 클릭합니다.

1장. RHEL에서 가상화 소개

가상화 또는 Linux에서의 구현이라는 개념에 익숙하지 않은 경우 다음 섹션에서는 RHEL 9의 가상화에 대한 일반적인 개요: Red Hat에서 제공하는 기본 사항, 이점, 구성 요소 및 기타 가능한 가상화 솔루션을 제공합니다.

1.1. 가상화란 무엇입니까?

RHEL 9에서는 RHEL 9를 실행하는 머신이 게스트 라고도 하는 여러 VM(가상 머신)을 호스팅 할 수 있는 가상화 기능을 제공합니다. VM은 호스트의 물리적 하드웨어 및 컴퓨팅 리소스를 사용하여 별도의게스트 OS(가상 운영 체제)를 호스트 운영 체제의 사용자 공간 프로세스로 실행합니다.

즉, 가상화를 통해 운영 체제 내에서 운영 체제를 사용할 수 있습니다.

VM을 사용하면 소프트웨어 구성 및 기능을 안전하게 테스트하거나 레거시 소프트웨어를 실행하거나 하드웨어의 워크로드 효율성을 최적화할 수 있습니다. 이점에 대한 자세한 내용은 가상화를 참조하십시오.

가상화에 대한 자세한 내용은 가상화 주제 페이지를 참조하십시오.

다음 단계

- Red Hat Enterprise Linux 9에서 가상화 사용을 시작하려면 Red Hat Enterprise Linux 9에서 가상화 활성화를 참조하십시오.

- Red Hat은 Red Hat Enterprise Linux 9 가상화 외에도 각각 다른 사용자 중심과 기능을 갖춘 다양한 전문 가상화 솔루션을 제공합니다. 자세한 내용은 Red Hat 가상화 솔루션을 참조하십시오.

1.2. 가상화의 이점

VM(가상 머신)을 사용하면 물리적 머신 사용과 비교할 때 다음과 같은 이점이 있습니다.

유연하고 세분화된 리소스 할당

VM은 일반적으로 물리적인 호스트 시스템에서 실행되며 게스트 OS가 사용할 물리적 하드웨어를 할당할 수도 있습니다. 그러나 VM에 물리적 리소스의 할당은 소프트웨어 수준에서 수행되므로 매우 유연합니다. VM은 호스트 메모리, CPU 또는 스토리지 공간의 구성 가능한 일부를 사용하며 해당 구성으로 매우 세분화된 리소스 요청을 지정할 수 있습니다.

예를 들어 게스트 OS가 디스크로 표시되는 것은 호스트 파일 시스템에서 파일로 표시될 수 있으며 해당 디스크의 크기는 물리적 디스크에 사용 가능한 크기보다 덜 제한됩니다.

소프트웨어 제어 구성

VM의 전체 구성은 호스트에 데이터로 저장되며 소프트웨어 제어하에 있습니다. 따라서 VM을 쉽게 생성, 제거, 복제, 마이그레이션, 운영하거나 원격 스토리지에 연결할 수 있습니다.

호스트와 분리

게스트 OS는 호스트 OS와는 별도로 가상화된 커널에서 실행됩니다. 즉, 모든 OS를 VM에 설치할 수 있으며 게스트 OS가 불안정하거나 손상된 경우에도 호스트는 영향을 받지 않습니다.

공간 및 비용 효율성

단일 물리 시스템은 다수의 VM을 호스팅할 수 있습니다. 따라서 여러 물리적 시스템이 동일한 작업을 수행할 필요가 없으므로 물리적 하드웨어와 관련된 공간, 전원 및 유지 관리 요구 사항을 줄일 수 있습니다.

소프트웨어 호환성

VM은 호스트와 다른 OS를 사용할 수 있으므로 가상화를 통해 호스트 OS용으로 원래 릴리스되지 않은 애플리케이션을 실행할 수 있습니다. 예를 들어 RHEL 7 게스트 OS를 사용하면 RHEL 9 호스트 시스템에서 RHEL 7용으로 릴리스된 애플리케이션을 실행할 수 있습니다.

참고모든 운영 체제가 RHEL 9 호스트에서 게스트 OS로 지원되는 것은 아닙니다. 자세한 내용은 RHEL 9 가상화의 권장 기능을 참조하십시오.

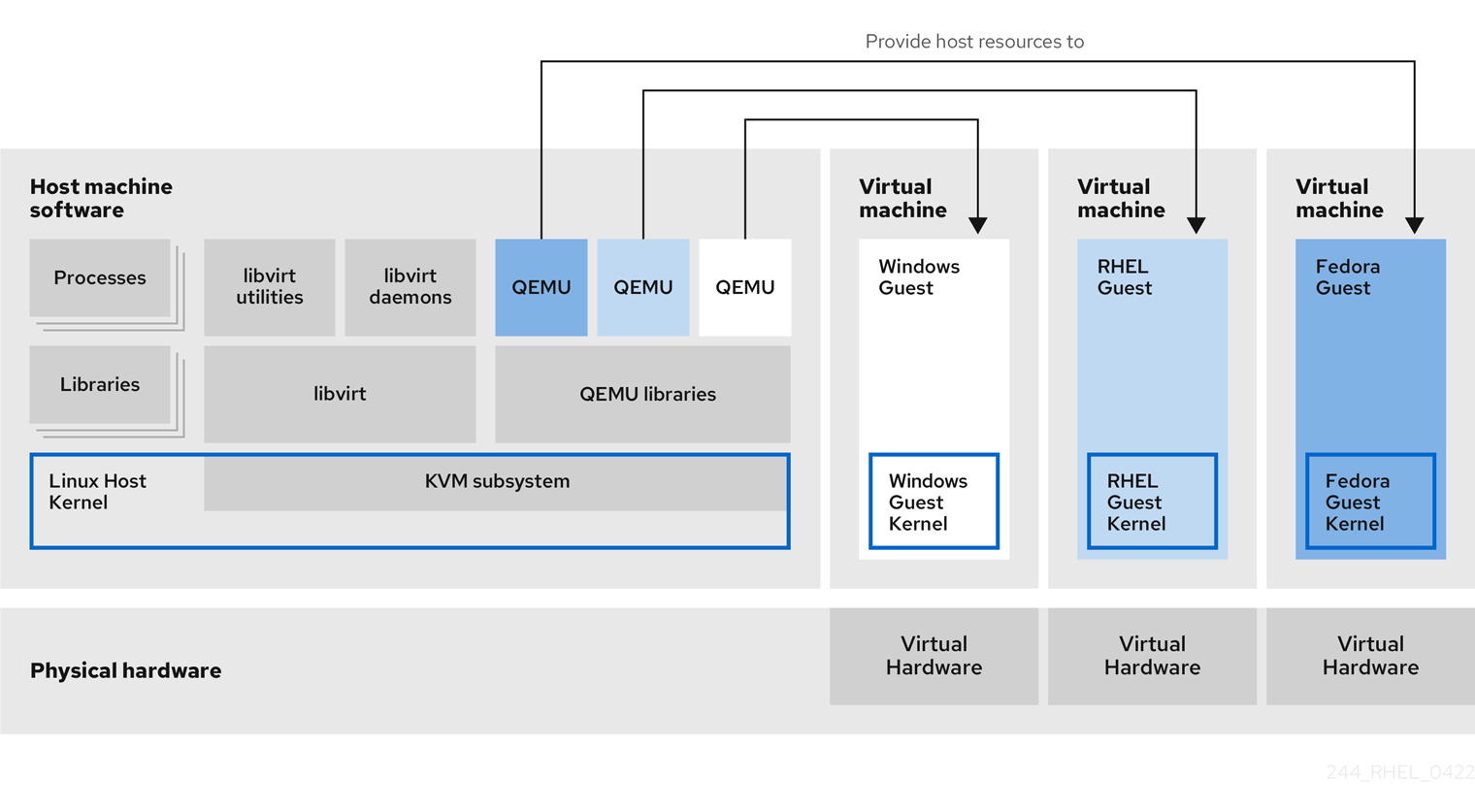

1.3. 가상 머신 구성 요소 및 상호 작용

RHEL 9의 가상화는 다음과 같은 주요 소프트웨어 구성 요소로 구성됩니다.

하이퍼바이저

RHEL 9에서 VM(가상 머신) 생성의 기반은 하드웨어를 제어하고 호스트 시스템에서 여러 운영 체제를 실행할 수 있는 소프트웨어 계층인 하이퍼바이저 입니다.

하이퍼바이저에는 KVM(커널 기반 가상 시스템) 모듈과 가상화 커널 드라이버가 포함되어 있습니다. 이러한 구성 요소를 사용하면 호스트 시스템의 Linux 커널이 가상화에 대한 리소스를 사용자 공간 소프트웨어에 제공합니다.

사용자 공간 수준에서 QEMU 에뮬레이터는 게스트 운영 체제를 실행할 수 있는 완전한 가상화 하드웨어 플랫폼을 시뮬레이션하고 호스트에 리소스가 할당되어 게스트에 표시되는 방법을 관리합니다.

또한 libvirt 소프트웨어 제품군은 관리 및 통신 계층 역할을 하므로 QEMU를 보다 쉽게 상호 작용하고 보안 규칙을 시행하며 VM 구성 및 실행을 위한 다양한 추가 툴을 제공합니다.

XML 구성

호스트 기반 XML 구성 파일( 도메인 XML 파일이라고도 함)은 특정 VM의 모든 설정 및 장치를 결정합니다. 구성에는 다음이 포함됩니다.

- VM의 이름, 시간대 및 VM에 대한 기타 정보와 같은 메타데이터입니다.

- 가상 CPU(vCPUS), 스토리지 장치, 입력/출력 장치, 네트워크 인터페이스 카드 및 기타 하드웨어, 실제 및 가상을 포함하여 VM의 장치에 대한 설명입니다.

- VM 설정(예: VM 동작에 대한 사용, 재시작 설정 및 기타 설정)을 사용할 수 있는 최대 메모리 양입니다.

XML 구성 콘텐츠에 대한 자세한 내용은 샘플 가상 머신 XML 구성 을 참조하십시오.

구성 요소 상호 작용

VM이 시작되면 하이퍼바이저는 XML 구성을 사용하여 VM 인스턴스를 호스트에서 사용자 공간 프로세스로 생성합니다. 하이퍼바이저는 또한 virsh,virt-install, guestfish 유틸리티 또는 웹 콘솔 GUI와 같은 호스트 기반 인터페이스에 VM 프로세스에 액세스할 수 있도록 합니다.

이러한 가상화 툴을 사용하면 libvirt가 입력을 QEMU 지침으로 변환합니다. QEMU는 명령을 수행하는 데 필요한 리소스를 적절하게 할당할 수 있도록 KVM에 지침을 전달합니다. 결과적으로 QEMU는 VM 생성 또는 수정과 같은 해당 사용자 공간 변경 사항을 실행하거나 VM의 게스트 운영 체제에서 작업을 수행할 수 있습니다.

QEMU는 아키텍처의 필수 구성 요소이지만 보안 문제로 인해 RHEL 9 시스템에서 직접 사용할 수 없습니다. 따라서 qemu-* 명령은 Red Hat에서 지원되지 않으므로 libvirt를 사용하여 QEMU와 상호 작용하는 것이 좋습니다.

호스트 기반 인터페이스에 대한 자세한 내용은 가상화 관리를 위한 툴 및 인터페이스를 참조하십시오.

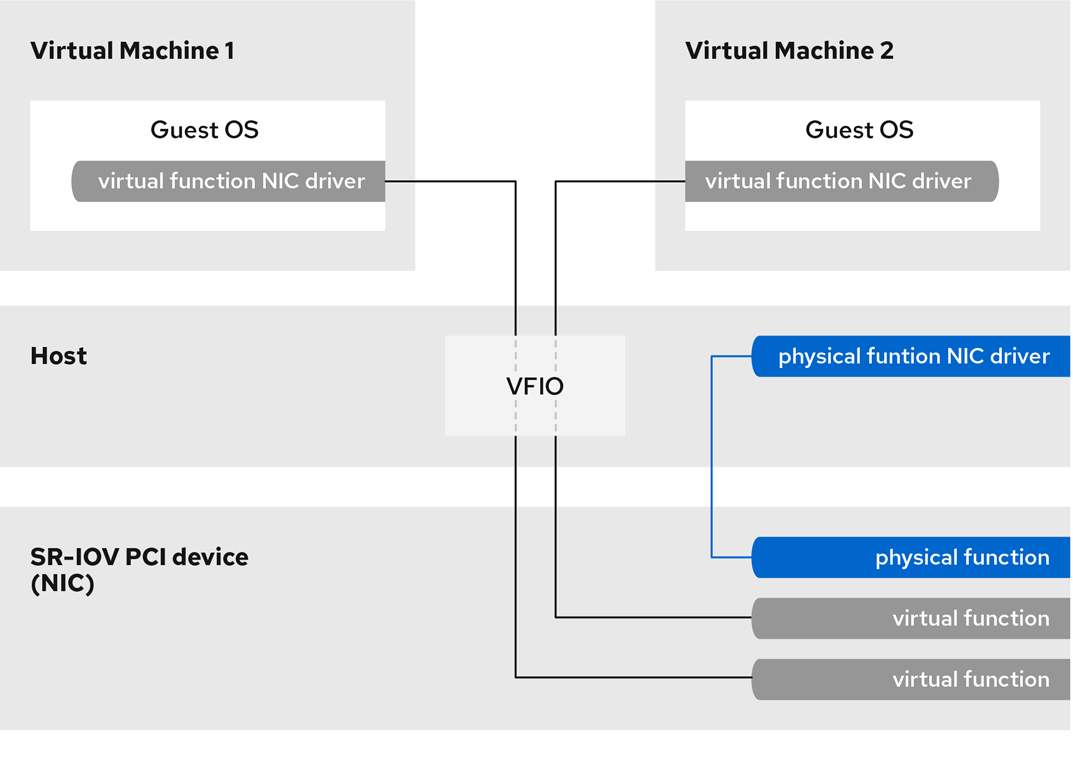

그림 1.1. RHEL 9 가상화 아키텍처

1.4. 가상화 관리를 위한 툴 및 인터페이스

CLI(명령줄 인터페이스) 또는 여러 GUI(그래픽 사용자 인터페이스)를 사용하여 RHEL 9에서 가상화를 관리할 수 있습니다.

명령줄 인터페이스

CLI는 RHEL 9에서 가상화를 관리하는 가장 강력한 방법입니다. VM(가상 머신) 관리를 위한 중요한 CLI 명령은 다음과 같습니다.

virsh - 제공된 인수에 따라 다양한 용도로 사용할 수 있는 가상화 명령줄 유틸리티 및 쉘입니다. 예를 들면 다음과 같습니다.

-

VM 시작 및 종료 -

virsh start및virsh shutdown -

사용 가능한 VM 나열 -

virsh list -

구성 파일에서 VM 생성 -

virsh create -

가상화 쉘 입력 -

virsh

자세한 내용은 시스템의

virsh(1)도움말 페이지를 참조하십시오.-

VM 시작 및 종료 -

-

virt-install- 새 VM을 생성하기 위한 CLI 유틸리티입니다. 자세한 내용은 시스템의virt-install(1)매뉴얼 페이지를 참조하십시오. -

virt-xml- VM 구성을 편집하는 유틸리티입니다. -

guestfish- VM 디스크 이미지 검사 및 수정을 위한 유틸리티입니다. 자세한 내용은 시스템의guestfish(1)매뉴얼 페이지를 참조하십시오.

그래픽 인터페이스

다음 GUI를 사용하여 RHEL 9에서 가상화를 관리할 수 있습니다.

Cockpit 라고도 하는 RHEL 9 웹 콘솔 은 VM 및 가상화 호스트를 관리하기 위해 원격으로 액세스할 수 있고 사용하기 쉬운 그래픽 사용자 인터페이스를 제공합니다.

웹 콘솔을 사용한 기본 가상화 관리에 대한 지침은 웹 콘솔에서 가상 머신 관리를 참조하십시오.

1.5. Red Hat Virtualization 솔루션

다음 Red Hat 제품은 RHEL 9 가상화 기능을 기반으로 구축되며 RHEL 9에서 사용할 수 있는 KVM 가상화 기능을 확장합니다. 또한 RHEL 9 가상화의 많은 제한 사항은 다음 제품에 적용되지 않습니다.

- OpenShift Virtualization

KubeVirt 기술을 기반으로 OpenShift Virtualization은 Red Hat OpenShift Container Platform의 일부이며 컨테이너에서 가상 머신을 실행할 수 있습니다.

OpenShift Virtualization에 대한 자세한 내용은 Red Hat Hybrid Cloud 페이지를 참조하십시오.

- Red Hat OpenStack Platform (RHOSP)

Red Hat OpenStack Platform은 안전하고 안정적인 퍼블릭 또는 프라이빗 OpenStack 클라우드를 구축, 배포 및 확장할 수 있는 통합 기반을 제공합니다.

Red Hat OpenStack Platform에 대한 자세한 내용은 Red Hat Customer Portal 또는 Red Hat OpenStack Platform 설명서 제품군 을 참조하십시오.

RHEL에서 지원되지 않지만 다른 Red Hat 가상화 솔루션에서 지원되는 가상화 기능에 대한 자세한 내용은 RHEL 9 가상화에서 지원되지 않는 기능을참조하십시오.

2장. 가상화 활성화

RHEL 9에서 가상화를 사용하려면 가상화 패키지를 설치하고 시스템이 VM(가상 머신)을 호스팅하도록 구성되어 있는지 확인해야 합니다. 이를 수행하는 특정 단계는 CPU 아키텍처에 따라 다릅니다.

2.1. AMD64 및 Intel 64에서 가상화 활성화

RHEL 9를 실행하는 AMD64 또는 Intel 64 시스템에서 KVM 하이퍼바이저를 설정하고 VM(가상 머신)을 생성하려면 아래 지침을 따르십시오.

사전 요구 사항

- Red Hat Enterprise Linux 9가 호스트 시스템에 설치되어 등록되었습니다.

시스템은 가상화 호스트로 작동하기 위해 다음과 같은 하드웨어 요구 사항을 충족합니다.

- 호스트 머신의 아키텍처는 KVM 가상화를 지원합니다.

다음과 같은 최소 시스템 리소스를 사용할 수 있습니다.

- 6GB의 호스트용 디스크 공간과 의도한 각 VM에 대해 6GB의 디스크 공간이 추가로 제공됩니다.

- 호스트용 2GB의 RAM과 의도한 각 VM에 대해 2GB를 더합니다.

프로세스

가상화 하이퍼바이저 패키지를 설치합니다.

# dnf install qemu-kvm libvirt virt-install virt-viewer가상화 서비스를 시작합니다.

# for drv in qemu network nodedev nwfilter secret storage interface; do systemctl start virt${drv}d{,-ro,-admin}.socket; done

검증

시스템이 가상화 호스트가 될 준비가 되었는지 확인합니다.

# virt-host-validate [...] QEMU: Checking for device assignment IOMMU support : PASS QEMU: Checking if IOMMU is enabled by kernel : WARN (IOMMU appears to be disabled in kernel. Add intel_iommu=on to kernel cmdline arguments) LXC: Checking for Linux >= 2.6.26 : PASS [...] LXC: Checking for cgroup 'blkio' controller mount-point : PASS LXC: Checking if device /sys/fs/fuse/connections exists : FAIL (Load the 'fuse' module to enable /proc/ overrides)모든 virt-host-validate 검사에서

PASS값을 반환하는 경우 시스템은 VM을 생성할 준비가 된 것입니다.검사 중

FAIL값을 반환하는 경우 표시된 지침을 따라 문제를 해결합니다.검사 중

WARN값을 반환하는 경우 표시된 지침에 따라 가상화 기능을 개선하십시오.

문제 해결

호스트 CPU에서 KVM 가상화를 지원하지 않는 경우 virt-host-validate 는 다음 출력을 생성합니다.

QEMU: Checking for hardware virtualization: FAIL (Only emulated CPUs are available, performance will be significantly limited)그러나 이러한 호스트 시스템의 VM은 성능 문제가 없는 대신 부팅되지 않습니다.

이 문제를 해결하려면 VM의 XML 구성에서 <

domain type> 값을qemu로 변경할 수 있습니다. 그러나 Red Hat은qemu도메인 유형을 사용하는 VM을 지원하지 않으며 프로덕션 환경에서는 이 값을 설정하지 않는 것이 좋습니다.

2.2. IBM Z에서 가상화 활성화

RHEL 9를 실행하는 IBM Z 시스템에서 KVM 하이퍼바이저를 설정하고 VM(가상 머신)을 생성하려면 아래 지침을 따르십시오.

사전 요구 사항

다음과 같은 최소 시스템 리소스를 사용할 수 있습니다.

- 6GB의 호스트용 디스크 공간과 의도한 각 VM에 대해 6GB의 디스크 공간이 추가로 제공됩니다.

- 호스트용 2GB의 RAM과 의도한 각 VM에 대해 2GB를 더합니다.

- 호스트의 CPU 4개 VM은 일반적으로 단일 할당된 vCPU로 실행할 수 있지만 Red Hat은 VM당 2개 이상의 vCPU를 할당하여 부하가 높은 동안 VM이 응답하지 않도록 하는 것이 좋습니다.

- IBM Z 호스트 시스템에서 z13 CPU 이상을 사용하고 있습니다.

RHEL 9는 논리 파티션(LPAR)에 설치됩니다. 또한 LPAR은 SIE( Start-interpretive Execution ) 가상화 기능을 지원합니다.

이를 확인하려면

/proc/cpuinfo파일에서sie를 검색합니다.# grep sie /proc/cpuinfo features : esan3 zarch stfle msa ldisp eimm dfp edat etf3eh highgprs te sie

프로세스

가상화 패키지를 설치합니다.

# dnf install qemu-kvm libvirt virt-install가상화 서비스를 시작합니다.

# for drv in qemu network nodedev nwfilter secret storage interface; do systemctl start virt${drv}d{,-ro,-admin}.socket; done

검증

시스템이 가상화 호스트가 될 준비가 되었는지 확인합니다.

# virt-host-validate [...] QEMU: Checking if device /dev/kvm is accessible : PASS QEMU: Checking if device /dev/vhost-net exists : PASS QEMU: Checking if device /dev/net/tun exists : PASS QEMU: Checking for cgroup 'memory' controller support : PASS QEMU: Checking for cgroup 'memory' controller mount-point : PASS [...]모든 virt-host-validate 검사에서

PASS값을 반환하는 경우 시스템은 VM을 생성할 준비가 된 것입니다.검사 중

FAIL값을 반환하는 경우 표시된 지침을 따라 문제를 해결합니다.검사 중

WARN값을 반환하는 경우 표시된 지침에 따라 가상화 기능을 개선하십시오.

문제 해결

호스트 CPU에서 KVM 가상화를 지원하지 않는 경우 virt-host-validate 는 다음 출력을 생성합니다.

QEMU: Checking for hardware virtualization: FAIL (Only emulated CPUs are available, performance will be significantly limited)그러나 이러한 호스트 시스템의 VM은 성능 문제가 없는 대신 부팅되지 않습니다.

이 문제를 해결하려면 VM의 XML 구성에서 <

domain type> 값을qemu로 변경할 수 있습니다. 그러나 Red Hat은qemu도메인 유형을 사용하는 VM을 지원하지 않으며 프로덕션 환경에서는 이 값을 설정하지 않는 것이 좋습니다.

2.3. ARM 64에서 가상화 활성화

RHEL 9를 실행하는 ARM 64 시스템( AArch64라고도 함)에서 VM(가상 머신)을 생성하기 위한 KVM 하이퍼바이저를 설정하려면 아래 지침을 따르십시오.

사전 요구 사항

- 호스트 시스템과 게스트 시스템은 64KB 메모리 페이지 크기가 있는 커널을 사용합니다. RHEL 시스템에 이러한 커널을 설치하려면 ARM에 커널-64k 설치를 참조하십시오.

다음과 같은 최소 시스템 리소스를 사용할 수 있습니다.

- 6GB의 호스트용 디스크 공간과 의도한 각 게스트당 6GB의 디스크 공간이 추가로 제공됩니다.

- 호스트용 4GB의 RAM과 의도한 게스트마다 4GB가 더 추가됩니다.

프로세스

가상화 패키지를 설치합니다.

# dnf install qemu-kvm libvirt virt-install가상화 서비스를 시작합니다.

# for drv in qemu network nodedev nwfilter secret storage interface; do systemctl start virt${drv}d{,-ro,-admin}.socket; done

검증

시스템이 가상화 호스트가 될 준비가 되었는지 확인합니다.

# virt-host-validate [...] QEMU: Checking if device /dev/vhost-net exists : PASS QEMU: Checking if device /dev/net/tun exists : PASS QEMU: Checking for cgroup 'memory' controller support : PASS QEMU: Checking for cgroup 'memory' controller mount-point : PASS [...] QEMU: Checking for cgroup 'blkio' controller support : PASS QEMU: Checking for cgroup 'blkio' controller mount-point : PASS QEMU: Checking if IOMMU is enabled by kernel : WARN (Unknown if this platform has IOMMU support)모든 virt-host-validate 검사에서

PASS값을 반환하는 경우 시스템은 가상 머신을 생성할 준비가 된 것입니다.검사 중

FAIL값을 반환하는 경우 표시된 지침을 따라 문제를 해결합니다.검사 중

WARN값을 반환하는 경우 표시된 지침에 따라 가상화 기능을 개선하십시오.

다음 단계

2.4. 가상 머신에서 QEMU 게스트 에이전트 기능 활성화

RHEL 9 시스템에서 호스팅되는 VM(가상 머신)에서 특정 기능을 사용하려면 먼저 QEMU 게스트 에이전트(GA)를 사용하도록 VM을 구성해야 합니다.

이러한 기능의 전체 목록은 QEMU 게스트 에이전트가 필요한 가상화 기능을 참조하십시오.

VM에서 QEMU GA를 구성하는 데 필요한 특정 단계는 VM에서 사용하는 게스트 운영 체제에 따라 다릅니다.

- Linux VM의 경우 Linux 게스트 에서 QEMU 게스트 에이전트 활성화를 참조하십시오.

- Windows VM의 경우 Windows 게스트 에서 QEMU 게스트 에이전트 활성화를 참조하십시오.

2.4.1. Linux 게스트에서 QEMU 게스트 에이전트 활성화

RHEL 호스트가 Linux 가상 머신(VM)에서 특정 작업 하위 집합 을 수행하도록 허용하려면 QEMU 게스트 에이전트(GA)를 활성화해야 합니다.

실행 중인 VM 및 종료 VM 모두에서 QEMU GA를 활성화할 수 있습니다.

프로세스

QEMU GA에 대한 XML 구성 파일을 생성합니다(예:

qemuga.xml:)# touch qemuga.xml파일에 다음 행을 추가합니다.

<channel type='unix'> <source mode='bind' path='/var/lib/libvirt/qemu/f16x86_64.agent'/> <target type='virtio' name='org.qemu.guest_agent.0'/> </channel>XML 파일을 사용하여 VM 구성에 QEMU GA를 추가합니다.

VM이 실행 중인 경우 다음 명령을 사용합니다.

# virsh attach-device <vm-name> qemuga.xml --live --configVM이 종료되면 다음 명령을 사용합니다.

# virsh attach-device <vm-name> qemuga.xml --config

Linux 게스트 운영 체제에서 QEMU GA를 설치합니다.

# dnf install qemu-guest-agent게스트에서 QEMU GA 서비스를 시작합니다.

# systemctl start qemu-guest-agent

검증

QEMU GA가 Linux VM에서 활성화되어 실행되고 있는지 확인하려면 다음 중 하나를 수행하십시오.

-

게스트 운영 체제에서

systemctl status qemu-guest-agent | grep Loaded명령을 사용합니다. 출력에활성화된 이/가포함된 경우 VM에서 QEMU GA가 활성화됩니다. -

호스트에서

virsh domfsinfo <vm-name>명령을 사용합니다. 출력이 표시되면 QEMU GA가 지정된 VM에서 활성화됩니다.

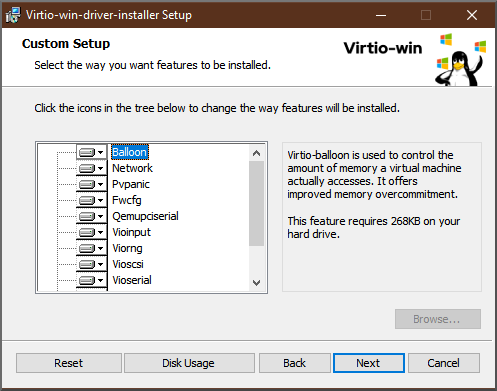

2.4.2. Windows 게스트에서 QEMU 게스트 에이전트 활성화

RHEL 호스트가 Windows 가상 머신(VM)에서 특정 작업 하위 집합 을 수행하도록 허용하려면 QEMU 게스트 에이전트(GA)를 활성화해야 합니다. 이렇게 하려면 QEMU 게스트 에이전트 설치 프로그램이 포함된 스토리지 장치를 기존 VM에 추가하거나 새 VM을 생성할 때 Windows 게스트 운영 체제에 드라이버를 설치합니다.

그래픽 인터페이스를 사용하여 게스트 에이전트(GA)를 설치하려면 아래 절차를 참조하십시오. 명령줄 인터페이스에서 GA를 설치하려면 MSI(Microsoft Windows Installer) 를 사용합니다.

사전 요구 사항

- 게스트 에이전트가 있는 설치 미디어가 VM에 연결되어 있습니다. 매체 준비에 대한 지침은 호스트 시스템에서 virtio 드라이버 설치 미디어 준비를 참조하십시오.

프로세스

-

Windows 게스트 운영 체제에서

File Explorer애플리케이션을 엽니다. -

이 PC를 클릭합니다. -

장치 및 드라이브창에서virtio-win미디어를 엽니다. -

guest-agent폴더를 엽니다. VM에 설치된 운영 체제를 기반으로 다음 설치 프로그램 중 하나를 실행합니다.

-

32비트 운영 체제를 사용하는 경우

qemu-ga-i386.msi설치 프로그램을 실행합니다. -

64비트 운영 체제를 사용하는 경우

qemu-ga-x86_64.msi설치 프로그램을 실행합니다.

-

32비트 운영 체제를 사용하는 경우

-

선택 사항: 반가상화 직렬 드라이버(

virtio-serial)를 호스트와 Windows 게스트 간의 통신 인터페이스로 사용하려면virtio-serial드라이버가 Windows 게스트에 설치되어 있는지 확인합니다.virtio드라이버 설치에 대한 자세한 내용은 Windows 게스트에 virtio 드라이버 설치를 참조하십시오.

검증

Windows VM에서 서비스 창으로 이동합니다.

컴퓨터 관리 > 서비스

-

QEMU 게스트 에이전트서비스의 상태가Running인지 확인합니다.

2.4.3. QEMU 게스트 에이전트가 필요한 가상화 기능

VM(가상 머신)에서 QEMU 게스트 에이전트(GA)를 활성화하는 경우 호스트에서 다음 명령을 사용하여 VM을 관리할 수 있습니다.

virsh shutdown --mode=agent-

QEMU GA와 함께 사용된

virsh shutdown은 정상 상태의 공동 게스트를 종료하는 것을 보장하므로 이 종료 방법은virsh shutdown --mode=acpi보다 안정적입니다.

virsh domfsfreeze및virsh domfsthaw- 게스트 파일 시스템을 별도로 중지합니다.

virsh domfstrim게스트에 파일 시스템을 트리밍하도록 지시하여 마이그레이션 중에 전송해야 하는 데이터를 줄이는 데 도움이 됩니다.

중요이 명령을 사용하여 Linux VM을 관리하려면 게스트 운영 체제에서 다음 SELinux 부울을 설정해야 합니다.

# setsebool virt_qemu_ga_read_nonsecurity_files onvirsh domtime- 게스트의 시계를 쿼리하거나 설정합니다.

virsh setvcpus --guest- 게스트에 CPU를 오프라인 상태로 전환하도록 지시합니다. 이는 CPU를 핫플러그할 수 없는 경우 유용합니다.

virsh domifaddr --source agent- QEMU GA를 사용하여 게스트 운영 체제의 IP 주소를 쿼리합니다. 예를 들어 게스트 인터페이스가 호스트 인터페이스에 직접 연결된 경우 유용합니다.

virsh domfsinfo- 실행 중인 게스트에 마운트된 파일 시스템 목록이 표시됩니다.

virsh set-user-password- 게스트에서 지정된 사용자 계정의 암호를 설정합니다.

virsh set-user-sshkeys게스트에서 지정된 사용자에 대해 인증된 SSH 키 파일을 편집합니다.

중요이 명령을 사용하여 Linux VM을 관리하려면 게스트 운영 체제에서 다음 SELinux 부울을 설정해야 합니다.

# setsebool virt_qemu_ga_manage_ssh on

3장. 가상 머신 생성

RHEL 9에서 VM(가상 머신)을 생성하려면 명령줄 인터페이스 또는 RHEL 9 웹 콘솔 을 사용합니다.

3.1. 명령줄 인터페이스를 사용하여 가상 머신 생성

virt-install 유틸리티를 사용하여 RHEL 9 호스트에서 VM(가상 머신)을 생성하려면 아래 지침을 따르십시오.

사전 요구 사항

- 호스트 시스템에서 가상화가 활성화되어 있습니다.

- 디스크 공간, RAM 또는 CPU와 같이 VM에 할당할 수 있는 충분한 시스템 리소스가 있습니다. 권장 값은 의도한 작업 및 VM의 워크로드에 따라 크게 다를 수 있습니다.

운영 체제(OS) 설치 소스는 로컬 또는 네트워크에서 사용할 수 있습니다. 다음 중 하나일 수 있습니다.

- 설치 미디어의 ISO 이미지

기존 VM 설치의 디스크 이미지

주의RHEL 9에서는 호스트 CD-ROM 또는 DVD-ROM 장치에서 설치할 수 없습니다. RHEL 9에서 사용 가능한 VM 설치 방법을 사용할 때 CD-ROM 또는 DVD-ROM을 설치 소스로 선택하면 설치에 실패합니다. 자세한 내용은 Red Hat 지식베이스 를 참조하십시오.

또한 Red Hat은 제한된 게스트 운영 체제 세트에 대해서만 지원을 제공합니다.

- 선택 사항: 설치보다 빠르고 쉽게 구성할 수 있도록 Kickstart 파일을 제공할 수 있습니다.

프로세스

VM을 생성하고 OS 설치를 시작하려면 다음 필수 인수와 함께 virt-install 명령을 사용합니다.

-

--name: 새 머신의 이름 -

--memory: 할당된 메모리 양 -

--vCPUs: 할당된 가상 CPU 수 -

--disk: 할당된 스토리지의 유형 및 크기 -

--CDROM 또는--location: OS 설치 소스의 유형 및 위치

선택한 설치 방법에 따라 필요한 옵션과 값은 다를 수 있습니다. 예는 아래 명령을 참조하십시오.

다음 명령은 /home/username/Downloads/Win10install.iso 파일에 로컬로 저장된 ISO 이미지에서 Windows 10 OS를 설치하는 demo-guest1 이라는 VM을 생성합니다. 이 VM에도 2048MiB의 RAM 및 2개의 vCPU가 할당되며 VM에 대해 80GiB qcow2 가상 디스크가 자동으로 구성됩니다.

# virt-install \ --name demo-guest1 --memory 2048 \ --vcpus 2 --disk size=80 --os-variant win10 \ --cdrom /home/username/Downloads/Win10install.iso다음 명령은 /home/username/Downloads/rhel9.iso 이미지를 사용하여 라이브 CD에서 RHEL 9 OS를 실행하는 demo-guest2 라는 VM을 생성합니다. 이 VM에 디스크 공간이 할당되지 않으므로 세션 중 변경한 내용은 유지되지 않습니다. 또한 VM에는 4096MiB의 RAM 및 4개의 vCPU가 할당됩니다.

# virt-install \ --name demo-guest2 --memory 4096 --vcpus 4 \ --disk none --livecd --os-variant rhel9.0 \ --cdrom /home/username/Downloads/rhel9.iso다음 명령은 기존 디스크 이미지 /home/username/backup/disk.qcow2 에 연결하는 demo-guest3 이라는 RHEL 9 VM을 생성합니다. 이는 시스템 간에 하드 드라이브를 물리적으로 이동하는 것과 유사하므로 demo-guest3에서 사용할 수 있는 OS와 데이터는 이전에 이미지가 어떻게 처리되었는지에 따라 결정됩니다. 또한 이 VM에는 2048MiB의 RAM 및 2개의 vCPU가 할당됩니다.

# virt-install \ --name demo-guest3 --memory 2048 --vcpus 2 \ --os-variant rhel9.0 --import \ --disk /home/username/backup/disk.qcow2디스크 이미지를 가져올 때

--os-variant옵션을 사용하는 것이 좋습니다. 제공되지 않으면 생성된 VM의 성능에 부정적인 영향을 미칩니다.다음 명령은

http://example.com/OS-installURL에서 설치하는 demo-guest4 라는 VM을 생성합니다. 설치가 성공적으로 시작하려면 URL에 작동 중인 OS 설치 트리가 포함되어야 합니다. 또한 OS는 /home/username/ks.cfg kickstart 파일을 사용하여 자동으로 구성됩니다. 이 VM에는 2048MiB의 RAM, vCPU 2개 및 160GiB qcow2 가상 디스크도 할당됩니다.# virt-install \ --name demo-guest4 --memory 2048 --vcpus 2 --disk size=160 \ --os-variant rhel9.0 --location http://example.com/OS-install \ --initrd-inject /home/username/ks.cfg --extra-args="inst.ks=file:/ks.cfg console=tty0 console=ttyS0,115200n8"또한 ARM 64 호스트의 RHEL 9에서 demo-guest4를 호스팅하려면 Kickstart 파일이

kernel-64k패키지를 설치할 수 있도록 다음 행을 포함합니다.%packages -kernel kernel-64k %end다음 명령은 그래픽 없이

RHEL9.iso이미지 파일에서 텍스트 전용 모드로 설치하는 demo-guest5 라는 VM을 생성합니다. 게스트 콘솔을 직렬 콘솔에 연결합니다. VM에는 16384MiB의 메모리, 16 vCPU 및 280GiB 디스크가 있습니다. 이러한 종류의 설치는 느린 네트워크 링크를 통해 호스트에 연결할 때 유용합니다.# virt-install \ --name demo-guest5 --memory 16384 --vcpus 16 --disk size=280 \ --os-variant rhel9.0 --location RHEL9.iso \ --graphics none --extra-args='console=ttyS0'다음 명령은 demo-guest5와 동일하지만 192.0.2.1 원격 호스트에 상주하는 demo-guest6 이라는 VM을 생성합니다.

# virt-install \ --connect qemu+ssh://root@192.0.2.1/system --name demo-guest6 --memory 16384 \ --vcpus 16 --disk size=280 --os-variant rhel9.0 --location RHEL9.iso \ --graphics none --extra-args='console=ttyS0'다음 명령은 demo-guest5와 동일한 구성이 있는 demo-guest-7 이라는 VM을 생성하여 스토리지의 경우 DASD 미디어 장치

mdev_308a6f_b1a5_4503_91ca_0c10ba12345a_0_0_29a8을 사용하여 장치 번호1111을 할당합니다.# virt-install \ --name demo-guest7 --memory 16384 --vcpus 16 --disk size=280 \ --os-variant rhel9.0 --location RHEL9.iso --graphics none \ --disk none --hostdev mdev_30820a6f_b1a5_4503_91ca_0c10ba12345a_0_0_29a8,address.type=ccw,address.cssid=0xfe,address.ssid=0x0,address.devno=0x1111,boot-order=1 \ --extra-args 'rd.dasd=0.0.1111'virsh nodedev-list --cap mdev명령을 사용하여 설치에 사용 가능한 미디어 장치의 이름을 검색할 수 있습니다.

검증

- VM이 성공적으로 생성되면 VM의 그래픽 콘솔이 포함된 virt-viewer 창이 열리고 게스트 OS 설치가 시작됩니다.

문제 해결

virt-install실패와 함께기본 네트워크 오류를 찾을 수 없는경우:libvirt-daemon-config-network패키지가 설치되었는지 확인합니다.# {PackageManagerCommand} info libvirt-daemon-config-network Installed Packages Name : libvirt-daemon-config-network [...]libvirt기본 네트워크가 활성 상태인지 확인하고 자동으로 시작하도록 구성되어 있는지 확인합니다.# virsh net-list --all Name State Autostart Persistent -------------------------------------------- default active yes yes그렇지 않은 경우 기본 네트워크를 활성화하고 auto-start로 설정합니다.

# virsh net-autostart default Network default marked as autostarted # virsh net-start default Network default started다음 오류와 함께 기본 네트워크를 활성화하면

libvirt-daemon-config-network패키지가 올바르게 설치되지 않았습니다.error: failed to get network 'default' error: Network not found: no network with matching name 'default'이 문제를 해결하려면

libvirt-daemon-config-network를 다시 설치합니다.# {PackageManagerCommand} reinstall libvirt-daemon-config-network기본 네트워크를 활성화하여 다음과 유사한 오류와 함께 실패하면 기본 네트워크의 서브넷과 호스트의 기존 인터페이스 간에 충돌이 발생했습니다.

error: Failed to start network default error: internal error: Network is already in use by interface ens2이 문제를 해결하려면

virsh net-edit 기본명령을 사용하고 구성의192.0.2.*값을 호스트에서 사용하지 않은 서브넷으로 변경합니다.

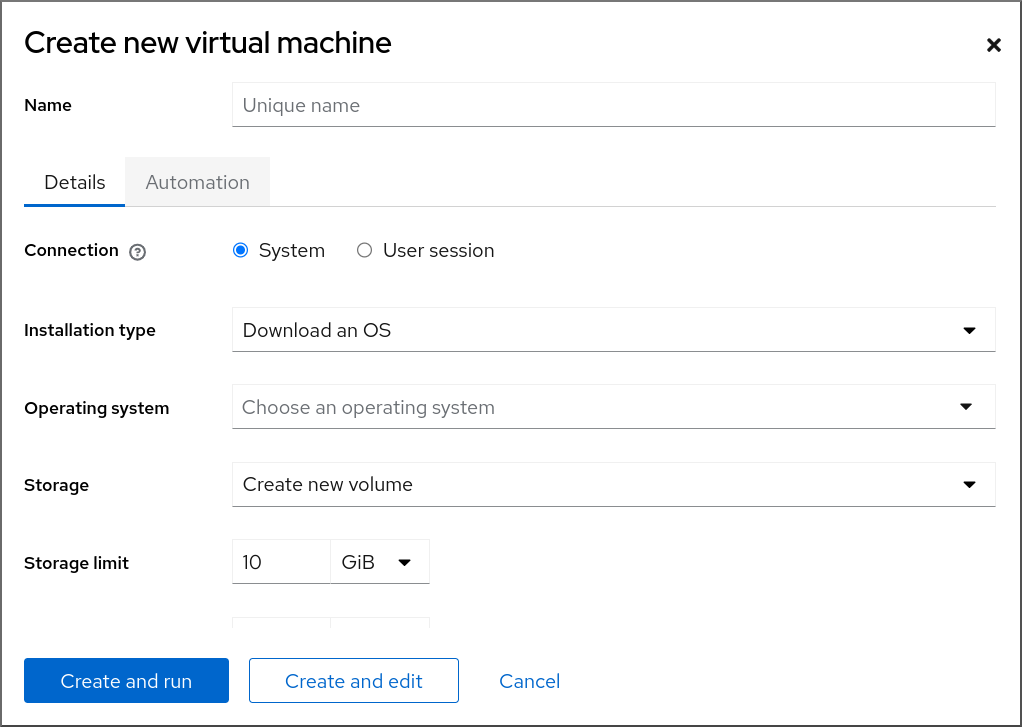

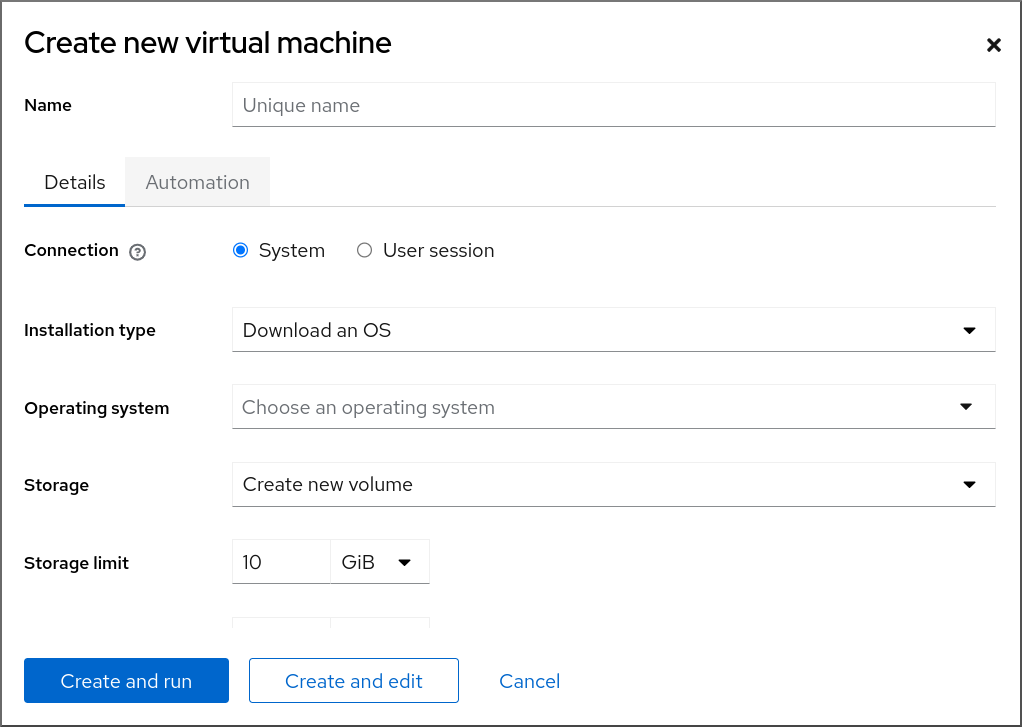

3.2. 웹 콘솔을 사용하여 가상 머신 생성 및 게스트 운영 체제 설치

RHEL 9 호스트의 GUI에서 VM(가상 머신)을 관리하려면 웹 콘솔을 사용합니다. 다음 섹션에서는 RHEL 9 웹 콘솔을 사용하여 VM을 생성하고 게스트 운영 체제를 설치하는 방법에 대한 정보를 제공합니다.

3.2.1. 웹 콘솔을 사용하여 가상 머신 생성

RHEL 9 웹 콘솔이 연결된 호스트 머신에 VM(가상 머신)을 생성하려면 아래 지침을 사용하십시오.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 호스트 시스템에서 가상화가 활성화되어 있습니다.

- 웹 콘솔 VM 플러그인이 호스트 시스템에 설치되어 있습니다.

- 디스크 공간, RAM 또는 CPU와 같이 VM에 할당할 수 있는 충분한 시스템 리소스가 있습니다. 권장 값은 의도한 작업 및 VM의 워크로드에 따라 크게 다를 수 있습니다.

프로세스

웹 콘솔 의 가상 머신 인터페이스에서 을 클릭합니다.

새 가상 머신 생성 대화 상자가 표시됩니다.

생성할 VM의 기본 구성을 입력합니다.

- name - VM의 이름입니다.

- 연결 - 세션에 부여된 권한 수준입니다. 자세한 내용은 웹 콘솔에서 연결된 대화 상자를 확장합니다.

- 설치 유형 - 설치 시 로컬 설치 미디어, URL, PXE 네트워크 부팅, 클라우드 기본 이미지를 사용하거나 제한된 운영 체제 세트에서 운영 체제를 다운로드할 수 있습니다.

운영 체제 - VM에서 실행되는 게스트 운영 체제입니다. Red Hat은 제한된 게스트 운영 체제 세트에 대해서만 지원을 제공합니다.

참고웹 콘솔에서 직접 Red Hat Enterprise Linux를 다운로드하고 설치하려면 오프라인 토큰 필드에 오프라인 토큰을 추가해야 합니다.

- storage - 스토리지의 유형입니다.

- 스토리지 제한 - 스토리지 공간의 크기입니다.

- memory - 메모리 양입니다.

VM을 생성합니다.

- VM이 운영 체제를 자동으로 설치하려면 .

- 운영 체제가 설치되기 전에 VM을 편집하려면 .

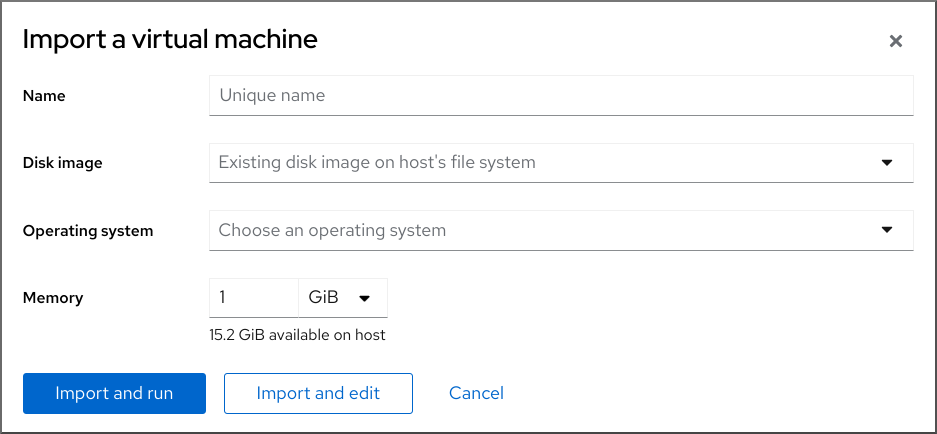

3.2.2. 웹 콘솔을 사용하여 디스크 이미지를 가져와 가상 머신 생성

RHEL 9 웹 콘솔에서 기존 VM 설치의 디스크 이미지를 가져와 VM(가상 머신)을 생성할 수 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

- 디스크 공간, RAM 또는 CPU와 같이 VM에 할당할 수 있는 충분한 시스템 리소스가 있습니다. 권장 값은 의도한 작업 및 VM의 워크로드에 따라 크게 다를 수 있습니다.

- 기존 VM 설치의 디스크 이미지를 다운로드했습니다.

프로세스

웹 콘솔 의 가상 머신 인터페이스에서 를 클릭합니다.

가상 머신 가져오기 대화 상자가 표시됩니다.

생성할 VM의 기본 구성을 입력합니다.

- name - VM의 이름입니다.

- 디스크 이미지 - 호스트 시스템에 있는 VM의 기존 디스크 이미지 경로입니다.

- 운영 체제 - VM 디스크에서 실행되는 운영 체제입니다. Red Hat은 제한된 게스트 운영 체제 세트에 대해서만 지원을 제공합니다.

- memory - VM에서 사용할 메모리 양입니다.

VM을 가져옵니다.

- VM 설정에 대한 추가 편집 없이 VM에 운영 체제를 설치하려면 클릭합니다.

- 운영 체제를 설치하기 전에 VM 설정을 편집하려면 클릭합니다.

3.2.3. 웹 콘솔을 사용하여 게스트 운영 체제 설치

VM(가상 머신)이 처음 부팅되는 경우 VM에 운영 체제를 설치해야 합니다.

새 VM을 생성하는 동안 또는 을 클릭하면 VM이 생성될 때 운영 체제에 대한 설치 루틴이 자동으로 시작됩니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 호스트 시스템에 설치되어 있습니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

가상 머신 인터페이스에서 게스트 OS를 설치할 VM을 클릭합니다.

선택한 VM에 대한 기본 정보와 VM의 다양한 측면을 관리하기 위한 새 페이지가 열립니다.

선택 사항: 펌웨어를 변경합니다.

참고새 VM을 생성하는 동안 OS가 VM에 아직 설치되지 않은 경우에만 펌웨어를 변경할 수 있습니다.

+ .. 펌웨어를 클릭합니다.

- 펌웨어 변경 창에서 필요한 펌웨어를 선택합니다.

- 을 클릭합니다.

클릭합니다.

운영 체제의 설치 루틴은 VM 콘솔에서 실행됩니다.

문제 해결

- 설치 루틴이 실패하면 설치를 다시 시작하기 전에 VM을 삭제하고 다시 생성합니다.

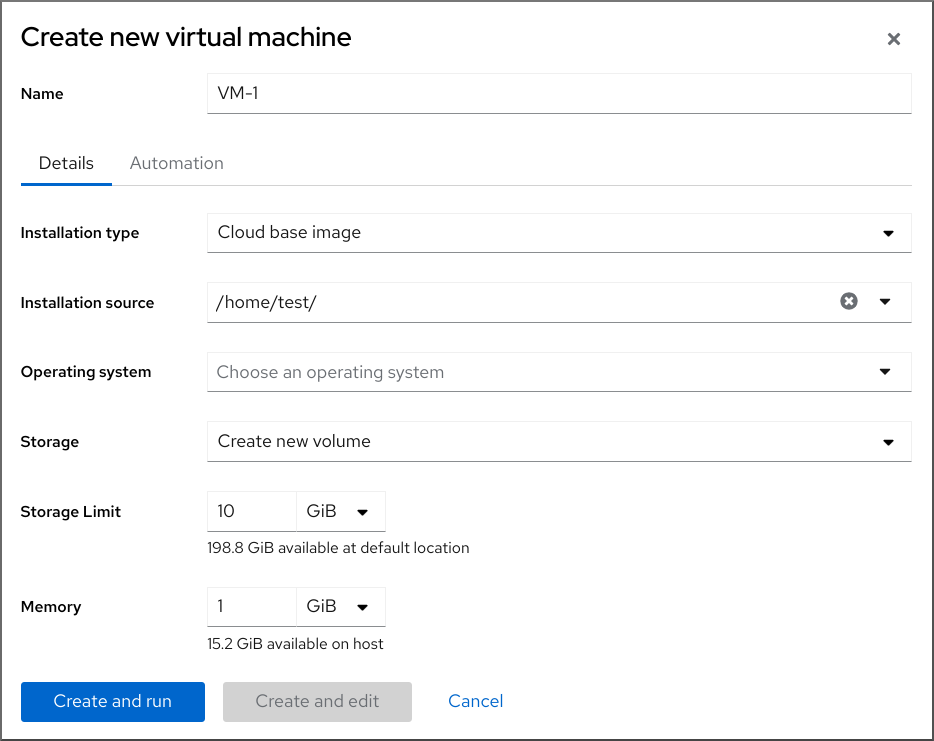

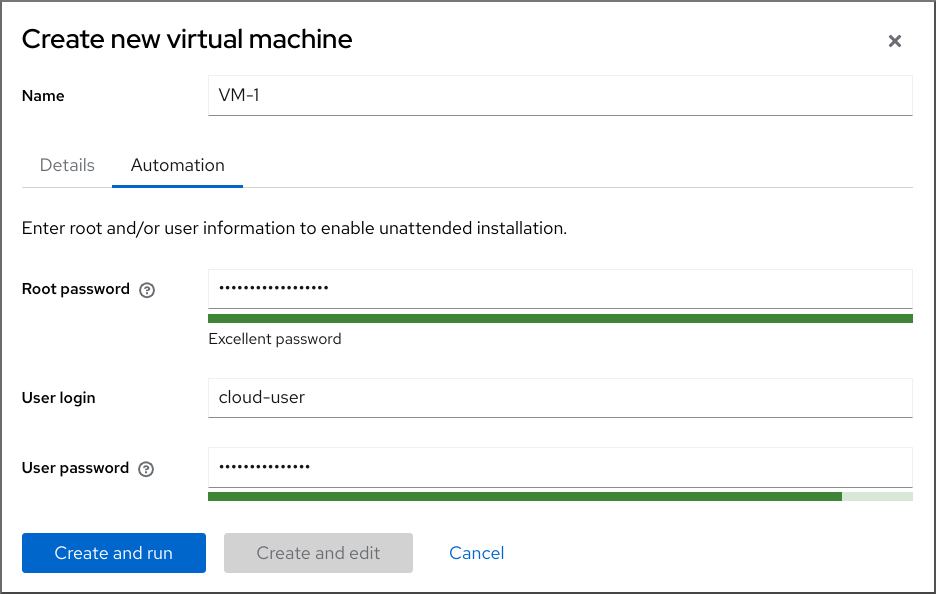

3.2.4. 웹 콘솔을 사용하여 클라우드 이미지 인증으로 가상 머신 생성

기본적으로 distro 클라우드 이미지에는 로그인 계정이 없습니다. 그러나 RHEL 웹 콘솔을 사용하면 이제 VM(가상 머신)을 생성하고 root 및 사용자 계정 로그인 인증 정보를 지정할 수 있습니다. 이 인증 정보는 cloud-init로 전달됩니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

- 호스트 시스템에서 가상화가 활성화되어 있습니다.

- 디스크 공간, RAM 또는 CPU와 같이 VM에 할당할 수 있는 충분한 시스템 리소스가 있습니다. 권장 값은 의도한 작업 및 VM의 워크로드에 따라 크게 다를 수 있습니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

웹 콘솔 인터페이스에서 을 클릭합니다.

새 가상 머신 생성 대화 상자가 표시됩니다.

- 이름 필드에 VM의 이름을 입력합니다.

세부 정보 탭의 설치 유형 필드에서 Cloud Base Image 를 선택합니다.

- 설치 소스 필드에서 호스트 시스템의 이미지 파일의 경로를 설정합니다.

생성할 VM의 구성을 입력합니다.

- 운영 체제 - VM의 운영 체제입니다. Red Hat은 제한된 게스트 운영 체제 세트에 대해서만 지원을 제공합니다.

- storage - VM을 구성할 스토리지 유형입니다.

- 스토리지 제한 - VM을 구성할 스토리지 공간의 크기입니다.

- memory - VM을 구성하는 메모리 양입니다.

자동화 탭을 클릭합니다.

클라우드 인증 자격 증명을 설정합니다.

- Root password - VM의 root 암호를 입력합니다. root 암호를 설정하지 않으려면 필드를 비워 둡니다.

- 사용자 로그인 - cloud-init 사용자 로그인을 입력합니다. 사용자 계정을 생성하지 않으려면 이 필드를 비워 둡니다.

사용자 암호 - 암호를 입력합니다. 사용자 계정을 생성하지 않으려면 이 필드를 비워 둡니다.

.

VM이 생성됩니다.

4장. 가상 머신 시작

RHEL 9에서 VM(가상 머신)을 시작하려면 명령줄 인터페이스 또는 웹 콘솔 GUI를 사용할 수 있습니다.

사전 요구 사항

- VM을 시작하기 전에 해당 VM을 생성해야 하며, 이상적으로 OS와 함께 설치해야 합니다. 이를 위한 지침은 가상 머신 생성 을 참조하십시오.

4.1. 명령줄 인터페이스를 사용하여 가상 머신 시작

CLI(명령줄 인터페이스)를 사용하여 종료 VM(가상 머신)을 시작하거나 저장된 VM을 복원할 수 있습니다. CLI를 사용하면 로컬 및 원격 VM을 모두 시작할 수 있습니다.

사전 요구 사항

- 이미 정의된 비활성 VM입니다.

- VM의 이름입니다.

원격 VM의 경우:

- VM이 있는 호스트의 IP 주소입니다.

- 호스트에 대한 루트 액세스 권한

프로세스

로컬 VM의 경우

virsh start유틸리티를 사용합니다.예를 들어 다음 명령은 demo-guest1 VM을 시작합니다.

# virsh start demo-guest1 Domain 'demo-guest1' started원격 호스트에 있는 VM의 경우 호스트에 대한 QEMU+SSH 연결과 함께

virsh start유틸리티를 사용합니다.예를 들어 다음 명령은 192.0.2.1 호스트에서 demo-guest1 VM을 시작합니다.

# virsh -c qemu+ssh://root@192.0.2.1/system start demo-guest1 root@192.0.2.1's password: Domain 'demo-guest1' started

4.2. 웹 콘솔을 사용하여 가상 머신 시작

VM(가상 머신)이 shut off 상태인 경우 RHEL 9 웹 콘솔을 사용하여 시작할 수 있습니다. 호스트가 시작될 때 자동으로 시작하도록 VM을 구성할 수도 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

- 이미 정의된 비활성 VM입니다.

- VM의 이름입니다.

프로세스

인터페이스에서 시작할 VM을 클릭합니다.

선택한 VM에 대한 자세한 정보와 함께 새 페이지가 열리고 VM 종료 및 삭제를 제어합니다.

클릭합니다.

VM이 시작되고 콘솔 또는 그래픽 출력에 연결할 수 있습니다.

선택 사항: 호스트가 시작될 때 자동으로 시작하도록 VM을 구성하려면 개요 섹션에서

자동 시작확인란을 전환합니다.libvirt에서 관리하지 않는 네트워크 인터페이스를 사용하는 경우 systemd 구성도 추가로 변경해야 합니다. 그렇지 않으면 영향을 받는 VM을 시작하지 못할 수 있습니다. 호스트가 시작될 때 자동으로 가상 머신 시작을 참조하십시오.

4.3. 호스트가 시작될 때 자동으로 가상 머신 시작

실행 중인 VM(가상 머신)이 있는 호스트가 다시 시작되면 VM이 종료되고 기본적으로 수동으로 다시 시작해야 합니다. 호스트가 실행될 때마다 VM이 활성화되도록 하려면 자동으로 시작하도록 VM을 구성할 수 있습니다.

사전 요구 사항

프로세스

virsh autostart유틸리티를 사용하여 호스트가 시작될 때 자동으로 시작하도록 VM을 구성합니다.예를 들어 다음 명령은 demo-guest1 VM이 자동으로 시작되도록 구성합니다.

# virsh autostart demo-guest1 Domain 'demo-guest1' marked as autostartedlibvirt에서 관리하지 않는 네트워크 인터페이스를 사용하는 경우 systemd 구성도 추가로 변경해야 합니다. 그렇지 않으면 영향을 받는 VM을 시작하지 못할 수 있습니다.참고이러한 인터페이스는 예를 들면 다음과 같습니다.

-

NetworkManager에서 생성한 브리지 장치 -

<

forward mode='bridge'/>를 사용하도록 구성된 네트워크

systemd 구성 디렉터리 트리에서

virtqemud.service.d디렉터리가 아직 없는 경우 해당 디렉터리를 생성합니다.# mkdir -p /etc/systemd/system/virtqemud.service.d/이전에 만든 디렉터리에서

10-network-online.confsystemd 장치 재정의 파일을 만듭니다. 이 파일의 내용은virtqemud서비스의 기본 systemd 구성을 재정의합니다.# touch /etc/systemd/system/virtqemud.service.d/10-network-online.conf10-network-online.conf파일에 다음 행을 추가합니다. 이 구성 변경을 통해 systemd는 호스트의 네트워크가 준비된 후에만virtqemud서비스를 시작할 수 있습니다.[Unit] After=network-online.target

-

검증

VM 구성을 보고 autostart 옵션이 활성화되어 있는지 확인합니다.

예를 들어 다음 명령은 autostart 옵션을 포함하여 demo-guest1 VM에 대한 기본 정보를 표시합니다.

# virsh dominfo demo-guest1 Id: 2 Name: demo-guest1 UUID: e46bc81c-74e2-406e-bd7a-67042bae80d1 OS Type: hvm State: running CPU(s): 2 CPU time: 385.9s Max memory: 4194304 KiB Used memory: 4194304 KiB Persistent: yes Autostart: enable Managed save: no Security model: selinux Security DOI: 0 Security label: system_u:system_r:svirt_t:s0:c873,c919 (enforcing)libvirt에서 관리하지 않는 네트워크 인터페이스를 사용하는 경우

10-network-online.conf파일의 콘텐츠가 다음 출력과 일치하는지 확인합니다.$ cat /etc/systemd/system/virtqemud.service.d/10-network-online.conf [Unit] After=network-online.target

5장. 가상 머신에 연결

RHEL 9의 VM(가상 머신)과 상호 작용하려면 다음 중 하나를 수행하여 VM에 연결해야 합니다.

- 웹 콘솔 인터페이스를 사용하는 경우 웹 콘솔 인터페이스에서 Virtual Machines 창을 사용합니다. 자세한 내용은 웹 콘솔을 사용하여 가상 머신과 상호 작용을 참조하십시오.

- 웹 콘솔을 사용하지 않고 VM 그래픽 디스플레이와 상호 작용해야 하는 경우 Virt Viewer 애플리케이션을 사용합니다. 자세한 내용은 Virt Viewer를 사용하여 가상 머신 그래픽 콘솔 열기를 참조하십시오.

- 그래픽 디스플레이가 불가능하거나 필요하지 않은 경우 SSH 터미널 연결을 사용합니다.

- 네트워크를 사용하여 시스템에서 가상 시스템에 연결할 수 없는 경우 virsh 콘솔을 사용합니다.

연결하는 VM이 로컬 호스트가 아닌 원격 호스트에 있는 경우 원격 호스트에 더 편리하게 액세스할 수 있도록 시스템을 구성할 수 있습니다.

5.1. 웹 콘솔을 사용하여 가상 머신과 상호 작용

RHEL 9 웹 콘솔의 VM(가상 머신)과 상호 작용하려면 VM 콘솔에 연결해야 합니다. 여기에는 그래픽 콘솔과 직렬 콘솔이 모두 포함됩니다.

- 웹 콘솔에서 VM의 그래픽 인터페이스와 상호 작용하려면 그래픽 콘솔을 사용합니다.

- 원격 뷰어에서 VM의 그래픽 인터페이스와 상호 작용하려면 원격 뷰어 에서 그래픽 콘솔을 사용합니다.

- 웹 콘솔에서 VM의 CLI와 상호 작용하려면 직렬 콘솔을 사용합니다.

5.1.1. 웹 콘솔에서 가상 머신 그래픽 콘솔 보기

VM(가상 머신) 콘솔 인터페이스를 사용하면 RHEL 9 웹 콘솔에서 선택한 VM의 그래픽 출력을 볼 수 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

- 호스트와 VM 둘 다 그래픽 인터페이스를 지원하는지 확인합니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

인터페이스에서 볼 그래픽 콘솔이 있는 VM을 클릭합니다.

VM에 대한 개요 및 콘솔 섹션이 포함된 새 페이지가 열립니다.

콘솔을 선택합니다.

VNC 콘솔은 웹 인터페이스의 메뉴 아래에 나타납니다.

그래픽 콘솔이 웹 인터페이스에 나타납니다.

확장을 클릭합니다

이제 실제 시스템과 상호 작용하는 것과 동일한 방식으로 마우스 및 키보드를 사용하여 VM 콘솔과 상호 작용할 수 있습니다. VM 콘솔의 디스플레이는 VM에서 수행되는 활동을 반영합니다.

웹 콘솔이 실행 중인 호스트는 Ctrl+Alt+Del 과 같은 특정 키 조합을 가로채어 VM으로 전송되지 않을 수 있습니다.

이러한 키 조합을 보내려면 메뉴를 클릭하고 전송할 키 시퀀스를 선택합니다.

예를 들어 VM에 Ctrl+Alt+Del 조합을 보내려면 클릭하고 메뉴 항목을 선택합니다.

문제 해결

- 그래픽 콘솔을 클릭해도 효과가 없는 경우 콘솔을 전체 화면으로 확장합니다. 마우스 커서 오프셋에서 알려진 문제입니다.

5.1.2. 웹 콘솔을 사용하여 원격 뷰어에서 그래픽 콘솔 보기

웹 콘솔 인터페이스를 사용하면 선택한 VM(가상 머신)의 그래픽 콘솔을 원격 뷰어(예: Virt Viewer)에 표시할 수 있습니다.

웹 콘솔 내에서 Virt Viewer를 시작할 수 있습니다. 다른 VNC 원격 뷰어는 수동으로 시작할 수 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

- 호스트와 VM 둘 다 그래픽 인터페이스를 지원하는지 확인합니다.

Virt Viewer에서 그래픽 콘솔을 보려면 먼저 웹 콘솔이 연결된 시스템에 Virt Viewer를 설치해야 합니다.

클릭합니다.

virt viewer,

.vv, 파일이 다운로드됩니다.- 파일을 열어 Virt Viewer를 시작합니다.

원격 뷰어는 대부분의 운영 체제에서 사용할 수 있습니다. 그러나 일부 브라우저 확장 및 플러그인에서는 웹 콘솔에서 Virt Viewer를 열 수 없습니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

인터페이스에서 볼 그래픽 콘솔이 있는 VM을 클릭합니다.

VM에 대한 개요 및 콘솔 섹션이 포함된 새 페이지가 열립니다.

콘솔 드롭다운 메뉴에서 선택합니다.

클릭합니다.

그래픽 콘솔이 Virt Viewer에서 열립니다.

실제 시스템과 상호 작용하는 것과 동일한 방식으로 마우스 및 키보드를 사용하여 VM 콘솔과 상호 작용할 수 있습니다. VM 콘솔의 디스플레이는 VM에서 수행되는 활동을 반영합니다.

웹 콘솔이 실행 중인 서버에서는 Ctrl+Alt+Del 과 같은 특정 키 조합을 가로챌 수 있으므로 VM으로 전송되지 않습니다.

이러한 키 조합을 보내려면 메뉴를 클릭하고 전송할 키 시퀀스를 선택합니다.

예를 들어 VM에 Ctrl+Alt+Del 조합을 보내려면 메뉴를 클릭하고 메뉴 항목을 선택합니다.

문제 해결

- 그래픽 콘솔을 클릭해도 효과가 없는 경우 콘솔을 전체 화면으로 확장합니다. 마우스 커서 오프셋에서 알려진 문제입니다.

웹 콘솔에서 원격 뷰어를 시작하지 않거나 최적이 아닌 경우 다음 프로토콜을 사용하여 뷰어 애플리케이션과 수동으로 연결할 수 있습니다.

-

address - 기본 주소는

127.0.0.1입니다./etc/libvirt/qemu.conf에서vnc_listen매개변수를 수정하여 호스트의 IP 주소로 변경할 수 있습니다. - VNC 포트 - 5901

-

address - 기본 주소는

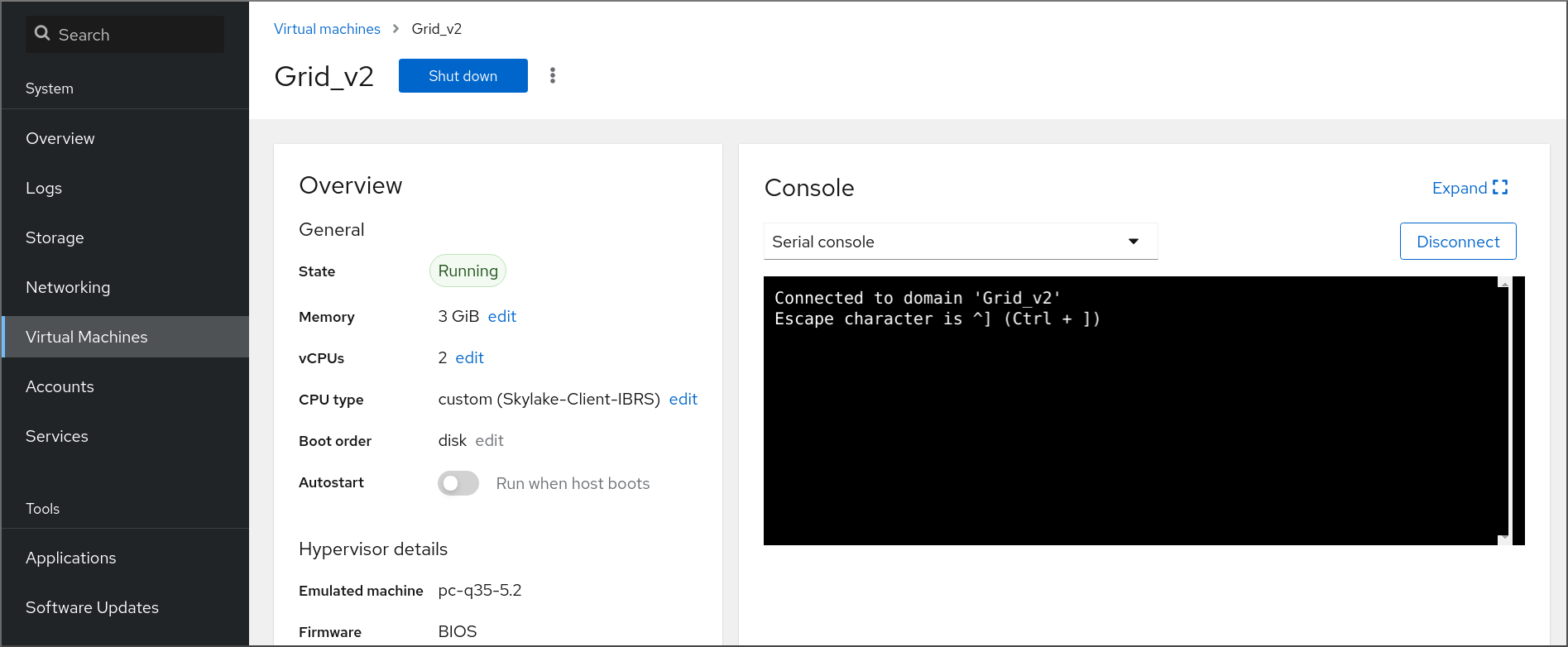

5.1.3. 웹 콘솔에서 가상 머신 직렬 콘솔 보기

RHEL 9 웹 콘솔에서 선택한 VM(가상 머신)의 직렬 콘솔을 볼 수 있습니다. 이 기능은 호스트 시스템 또는 VM이 그래픽 인터페이스로 구성되지 않은 경우 유용합니다.

직렬 콘솔에 대한 자세한 내용은 가상 머신 직렬 콘솔 열기를 참조하십시오.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

창에서 볼 직렬 콘솔이 있는 VM을 클릭합니다.

VM에 대한 개요 및 콘솔 섹션이 포함된 새 페이지가 열립니다.

콘솔을 선택합니다.

그래픽 콘솔이 웹 인터페이스에 나타납니다.

VM에서 직렬 콘솔의 연결을 해제하고 다시 연결할 수 있습니다.

- VM에서 직렬 콘솔의 연결을 끊으려면 를 클릭합니다.

- 직렬 콘솔을 VM에 다시 연결하려면 연결을 클릭합니다.

5.1.4. 웹 콘솔에서 SPICE 원격 디스플레이 프로토콜을 VNC로 교체

RHEL 9 호스트에서 SPICE 원격 디스플레이 프로토콜에 대한 지원이 제거되었습니다. SPICE 프로토콜을 사용하도록 구성된 VM(가상 머신)이 있는 경우 웹 콘솔을 사용하여 SPICE 프로토콜을 VNC 프로토콜로 교체할 수 있습니다. 그렇지 않으면 VM이 시작되지 않습니다.

그러나 오디오 및 USB 패스스루와 같은 특정 SPICE 장치는 VNC 프로토콜에 적합한 대체 장치가 없으므로 VM에서 제거됩니다. 자세한 내용은 RHEL 9 도입의 고려 사항을 참조하십시오.

기본적으로 RHEL 8 VM은 SPICE 프로토콜을 사용하도록 구성됩니다. SPICE에서 VNC로 전환하지 않는 한 RHEL 9 호스트에서 이러한 VM이 시작되지 않습니다.

사전 요구 사항

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

- SPICE 원격 디스플레이 프로토콜을 사용하도록 구성된 기존 VM이 있고 이미 종료되어 있습니다.

프로세스

웹 콘솔의 가상 인터페이스에서 SPICE 프로토콜을 사용하도록 구성된 VM의 메뉴 버튼 Cryostat를 클릭합니다.

다양한 VM 작업에 대한 제어가 포함된 드롭다운 메뉴가 열립니다.

클릭합니다.

SPICE 장치 교체 대화 상자가 열립니다.

참고SPICE 프로토콜을 사용하는 기존 VM이 여러 개 있는 경우 이 대화 상자에 나열됩니다. 여기에서 단일 단계에서 SPICE를 사용하여 VNC로 변환할 여러 VM을 선택할 수 있습니다.

클릭합니다.

성공적인 작업에 대한 확인이 나타납니다.

5.2. Virt Viewer를 사용하여 가상 머신 그래픽 콘솔 열기

KVM 가상 머신(VM)의 그래픽 콘솔에 연결하고 Virt Viewer 데스크탑 애플리케이션에서 열려면 아래 절차를 따르십시오.

사전 요구 사항

- 시스템 및 연결하는 VM은 그래픽 디스플레이를 지원해야 합니다.

- 대상 VM이 원격 호스트에 있는 경우 호스트에 대한 연결 및 루트 액세스 권한이 필요합니다.

- 선택 사항: 대상 VM이 원격 호스트에 있는 경우 원격 호스트에 더 편리하게 액세스할 수 있도록 libvirt 및 SSH를 설정합니다.

프로세스

로컬 VM에 연결하려면 다음 명령을 사용하고 guest-name 을 연결할 VM 이름으로 교체합니다.

# virt-viewer guest-name원격 VM에 연결하려면 SSH 프로토콜과 함께

virt-viewer명령을 사용합니다. 예를 들어 다음 명령은 원격 시스템 192.0.2.1에 있는 guest-name 이라는 VM에 root로 연결합니다. 이 연결에는 192.0.2.1에 대한 루트 인증도 필요합니다.# virt-viewer --direct --connect qemu+ssh://root@192.0.2.1/system guest-name root@192.0.2.1's password:

검증

연결이 올바르게 작동하는 경우 VM 디스플레이가 Virt Viewer 창에 표시됩니다.

실제 시스템과 상호 작용하는 것과 동일한 방식으로 마우스 및 키보드를 사용하여 VM 콘솔과 상호 작용할 수 있습니다. VM 콘솔의 디스플레이는 VM에서 수행되는 활동을 반영합니다.

문제 해결

- 그래픽 콘솔을 클릭해도 효과가 없는 경우 콘솔을 전체 화면으로 확장합니다. 마우스 커서 오프셋에서 알려진 문제입니다.

5.3. SSH를 사용하여 가상 머신에 연결

SSH 연결 프로토콜을 사용하여 VM(가상 머신) 터미널과 상호 작용하려면 다음 절차를 따르십시오.

사전 요구 사항

- 대상 VM에 대한 네트워크 연결 및 루트 액세스 권한이 있습니다.

- 대상 VM이 원격 호스트에 있는 경우 해당 호스트에 대한 연결 및 root 액세스 권한도 있습니다.

VM 네트워크는

libvirt에서 생성된dnsmasq에 의해 IP 주소를 할당합니다. 예를 들어libvirtNAT 네트워크의 경우입니다.특히 VM에서 다음 네트워크 구성 중 하나를 사용하는 경우 SSH를 사용하여 VM에 연결할 수 없습니다.

-

hostdev인터페이스 - 직접 인터페이스

- 브리지 상호 작용

-

libvirt-nss구성 요소가 VM의 호스트에 설치되어 활성화되어 있습니다. 그렇지 않은 경우 다음을 수행합니다.libvirt-nss패키지를 설치합니다.# dnf install libvirt-nss/etc/nsswitch.conf파일을 편집하고libvirt_guest를hosts행에 추가합니다.... passwd: compat shadow: compat group: compat hosts: files libvirt_guest dns ...

프로세스

원격 VM에 연결할 때 먼저 물리적 호스트에 SSH로 연결합니다. 다음 예제에서는 루트 자격 증명을 사용하여 호스트 시스템

192.0.2.1에 연결하는 방법을 보여줍니다.# ssh root@192.0.2.1 root@192.0.2.1's password: Last login: Mon Sep 24 12:05:36 2021 root~#VM의 이름과 사용자 액세스 자격 증명을 사용하여 연결합니다. 예를 들어 다음은 루트 인증 정보를 사용하여

testguest1VM에 연결합니다.# ssh root@testguest1 root@testguest1's password: Last login: Wed Sep 12 12:05:36 2018 root~]#

문제 해결

VM 이름을 모르는 경우

virsh list --all명령을 사용하여 호스트에서 사용 가능한 모든 VM을 나열할 수 있습니다.# virsh list --all Id Name State ---------------------------------------------------- 2 testguest1 running - testguest2 shut off

5.4. 가상 머신 직렬 콘솔 열기

virsh console 명령을 사용하면 VM(가상 머신)의 직렬 콘솔에 연결할 수 있습니다.

이 기능은 VM에서 사용할 때 유용합니다.

- VNC 프로토콜을 제공하지 않으므로 GUI 툴에 대한 비디오 디스플레이를 제공하지 않습니다.

- 에는 네트워크 연결이 없으므로 SSH를 사용하여 상호 작용할 수 없습니다.

사전 요구 사항

호스트의 GRUB 부트 로더는 직렬 콘솔을 사용하도록 구성해야 합니다. 확인하려면 호스트의

/etc/default/grub파일에GRUB_TERMINAL=serial매개변수가 포함되어 있는지 확인합니다.$ sudo grep GRUB_TERMINAL /etc/default/grub GRUB_TERMINAL=serialVM에는 콘솔

type='pty'와 같은 직렬 콘솔장치가 구성되어 있어야 합니다. 확인하려면 다음을 수행합니다.# virsh dumpxml vm-name | grep console <console type='pty' tty='/dev/pts/2'> </console>VM에는 커널 명령줄에 직렬 콘솔이 구성되어 있어야 합니다. 이를 확인하려면 VM의

cat /proc/cmdline명령 출력에 console=<console-name>이 포함되어야 합니다. 여기서 < console-name >은 아키텍처에 따라 다릅니다.-

AMD64 및 Intel 64의 경우:

ttyS0 ARM 64의 경우:

ttyAMA0참고이 절차의 다음 명령은

ttyS0을 사용합니다.# cat /proc/cmdline BOOT_IMAGE=/vmlinuz-3.10.0-948.el7.x86_64 root=/dev/mapper/rhel-root ro console=tty0 console=ttyS0,9600n8 rd.lvm.lv=rhel/root rd.lvm.lv=rhel/swap rhgb직렬 콘솔이 VM에 올바르게 설정되지 않은 경우 virsh 콘솔 을 사용하여 VM에 연결하면 응답하지 않는 게스트 콘솔에 연결됩니다. 그러나 Ctrl+] 바로 가기를 사용하여 응답하지 않는 콘솔을 계속 종료할 수 있습니다.

VM에서 직렬 콘솔을 설정하려면 다음을 수행합니다.

VM에서

console=ttyS0커널 옵션을 활성화합니다.# grubby --update-kernel=ALL --args="console=ttyS0"변경 사항이 적용되지 않을 수 있는 커널 옵션을 지웁니다.

# grub2-editenv - unset kernelopts- VM을 재부팅합니다.

-

AMD64 및 Intel 64의 경우:

serial-getty@<console-name>서비스를 활성화해야 합니다. 예를 들어 AMD64 및 Intel 64에서 다음을 수행합니다.# systemctl status serial-getty@ttyS0.service ○ serial-getty@ttyS0.service - Serial Getty on ttyS0 Loaded: loaded (/usr/lib/systemd/system/serial-getty@.service; enabled; preset: enabled)

프로세스

호스트 시스템에서

virsh console명령을 사용합니다. libvirt 드라이버가 안전한 콘솔 처리를 지원하는 경우 다음 예제는 guest1 VM에 연결합니다.# virsh console guest1 --safe Connected to domain 'guest1' Escape character is ^] Subscription-name Kernel 3.10.0-948.el7.x86_64 on an x86_64 localhost login:- 표준 명령줄 인터페이스와 동일한 방식으로 virsh 콘솔과 상호 작용할 수 있습니다.

5.5. 원격 가상화 호스트에 쉽게 액세스 가능

libvirt 유틸리티를 사용하여 원격 호스트 시스템에서 VM을 관리하는 경우 -c qemu+ssh://root@hostname/system 구문을 사용하는 것이 좋습니다. 예를 들어 192.0.2.1 호스트에서 root로 virsh list 명령을 사용하려면 다음을 수행합니다.

# virsh -c qemu+ssh://root@192.0.2.1/system list

root@192.0.2.1's password:

Id Name State

---------------------------------

1 remote-guest running그러나 SSH 및 libvirt 구성을 수정하여 연결 세부 정보를 완전히 지정해야 할 필요성을 제거할 수 있습니다. 예를 들면 다음과 같습니다.

# virsh -c remote-host list

root@192.0.2.1's password:

Id Name State

---------------------------------

1 remote-guest running이러한 개선을 활성화하려면 아래 지침을 따르십시오.

프로세스

다음 세부 정보를 사용하여

~/.ssh/config파일을 편집합니다. 여기서 host-alias 는 특정 원격 호스트와 관련된 단축된 이름 및 root@192.0.2.1의 별칭이며 hosturl 은 호스트의 URL 주소입니다.# vi ~/.ssh/config Host example-host-alias User root Hostname 192.0.2.1다음 세부 정보를 사용하여

/etc/libvirt/libvirt.conf파일을 편집합니다. example-qemu-host-alias 는 QEMU 및 libvirt 유틸리티가qemu+ssh://192.0.2.1/system에 대해 원하는 호스트 example-host-alias 와 연결하는 호스트 별칭입니다.# vi /etc/libvirt/libvirt.conf uri_aliases = [ "example-qemu-host-alias=qemu+ssh://example-host-alias/system", ]

검증

로컬 시스템에서

-c qemu-host-alias매개변수가 추가된 libvirt 기반 유틸리티를 사용하여 원격 VM을 관리할 수 있는지 확인합니다. 원격 호스트의 SSH를 통해 명령이 자동으로 수행됩니다.예를 들어 다음 항목이 192.0.2.1 원격 호스트의 VM을 나열하고, 에 대한 연결이 이전 단계에서 example-qemu-host-alias 로 설정되어 있는지 확인합니다.

# virsh -c example-qemu-host-alias list root@192.0.2.1's password: Id Name State ---------------------------------------- 1 example-remote-guest running참고virsh외에도-c(또는--connect) 옵션과 위에 설명된 원격 호스트 액세스 구성은 다음 유틸리티에서 사용할 수 있습니다.

다음 단계

단일 원격 호스트에서만 libvirt 유틸리티를 사용하려는 경우 libvirt 기반 유틸리티의 기본 대상으로 특정 연결을 설정할 수도 있습니다. 그러나 로컬 호스트 또는 다른 원격 호스트에서 VM을 관리하려는 경우에도 권장되지 않습니다.

/etc/libvirt/libvirt.conf파일을 편집하고uri_default매개변수 값을 기본 libvirt 대상으로 example-qemu-host-alias 로 설정할 수 있습니다.# These can be used in cases when no URI is supplied by the application # (@uri_default also prevents probing of the hypervisor driver). # uri_default = "example-qemu-host-alias"결과적으로 모든 libvirt 기반 명령이 지정된 원격 호스트에서 자동으로 수행됩니다.

$ virsh list root@192.0.2.1's password: Id Name State --------------------------------- 1 example-remote-guest running원격 호스트에 연결할 때 원격 시스템에 root 암호를 제공하지 않도록 할 수 있습니다. 이렇게 하려면 다음 방법 중 하나 이상을 사용합니다.

- 원격 호스트에 대한 키 기반 SSH 액세스 설정

- SSH 연결 멀티플렉싱을 사용하여 원격 시스템에 연결

- Identity Management의 Kerberos 인증

-

-c(또는--connect) 옵션을 사용하여 원격 호스트에서virt-install,virt-viewer및virsh명령을 실행할 수 있습니다.

6장. 가상 머신 종료

RHEL 9에서 호스팅되는 실행 중인 가상 머신을 종료하려면 명령줄 인터페이스 또는 웹 콘솔 GUI를 사용합니다.

6.1. 명령줄 인터페이스를 사용하여 가상 머신 종료

반응형 VM(가상 머신)을 종료하려면 다음 중 하나를 수행합니다.

- 게스트에 연결하는 동안 게스트 OS에 적절한 shutdown 명령을 사용합니다.

호스트에서

virsh shutdown명령을 사용합니다.VM이 로컬 호스트에 있는 경우:

# virsh shutdown demo-guest1 Domain 'demo-guest1' is being shutdownVM이 원격 호스트에 있는 경우 이 예제에서는 192.0.2.1입니다.

# virsh -c qemu+ssh://root@192.0.2.1/system shutdown demo-guest1 root@192.0.2.1's password: Domain 'demo-guest1' is being shutdown

VM을 강제로 종료하려면 예를 들어 응답하지 않는 경우 호스트에서 virsh destroy 명령을 사용합니다.

# virsh destroy demo-guest1

Domain 'demo-guest1' destroyed

virsh destroy 명령은 실제로 VM 구성 또는 디스크 이미지를 삭제하거나 제거하지 않습니다. 물리적 시스템에서 전원 코드를 가져오는 것과 유사하게 VM의 실행 중인 VM 인스턴스만 종료합니다. 이와 같이 드문 경우지만 virsh destroy 는 VM의 파일 시스템이 손상될 수 있으므로 다른 모든 종료 방법이 실패한 경우에만 이 명령을 사용하는 것이 좋습니다.

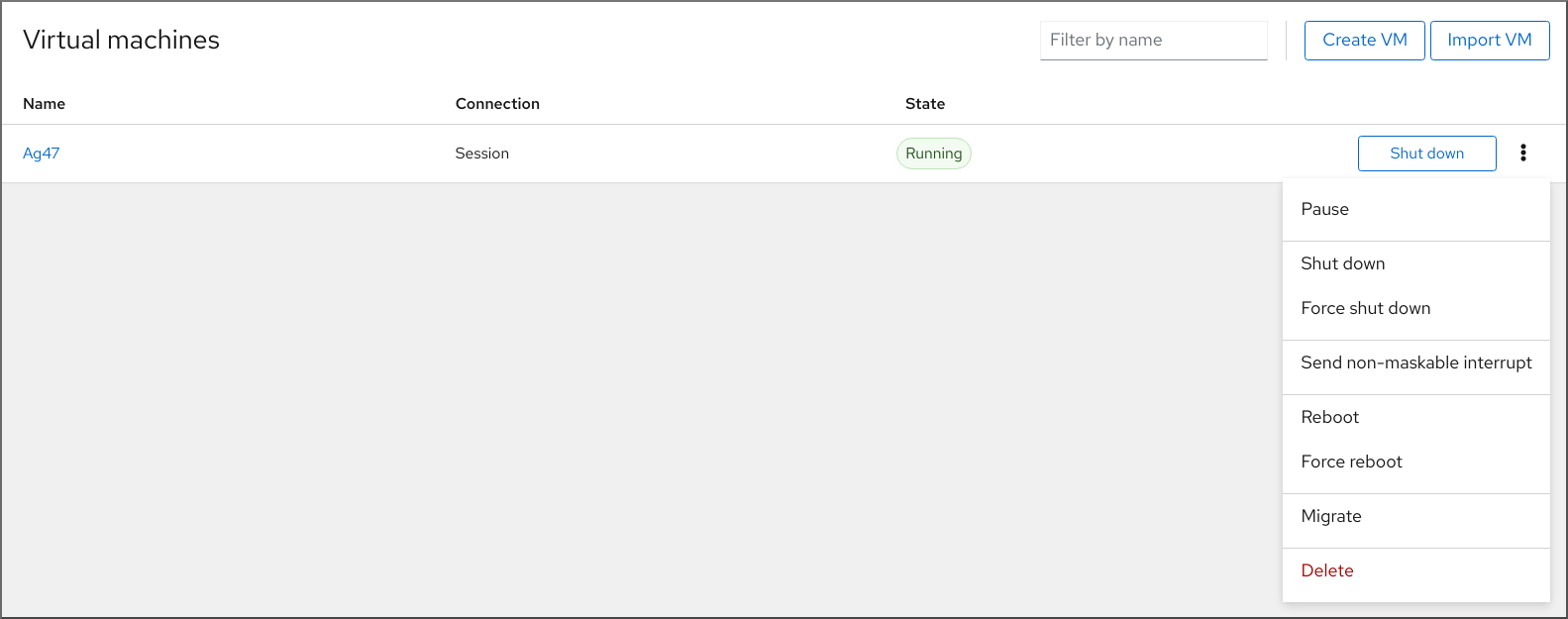

6.2. 웹 콘솔을 사용하여 가상 머신 종료 및 재시작

RHEL 9 웹 콘솔을 사용하여 실행 중인 가상 머신을 종료 하거나 다시 시작할 수 있습니다. 마스킹할 수 없는 인터럽트를 응답하지 않는 가상 머신에 보낼 수도 있습니다.

6.2.1. 웹 콘솔에서 가상 머신 종료

VM(가상 머신)이 실행 중 상태인 경우 RHEL 9 웹 콘솔을 사용하여 종료할 수 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

프로세스

- 인터페이스에서 종료할 VM 행을 찾습니다.

행 오른쪽에서 을 클릭합니다.

VM이 종료됩니다.

문제 해결

- VM이 종료되지 않으면 Shut Down 버튼 옆에 메뉴 버튼을 클릭하고 을 선택합니다.

- 응답하지 않는 VM을 종료하려면 마스킹할 수 없는 인터럽트를 보낼 수도 있습니다.

6.2.2. 웹 콘솔을 사용하여 가상 머신 재시작

VM(가상 머신)이 실행 중 상태인 경우 RHEL 9 웹 콘솔을 사용하여 다시 시작할 수 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

프로세스

- 인터페이스에서 재시작할 VM 행을 찾습니다.

행 오른쪽에 있는 메뉴 버튼을 클릭합니다

작업의 드롭다운 메뉴가 표시됩니다.

드롭다운 메뉴에서 를 클릭합니다.

VM이 종료되고 다시 시작됩니다.

문제 해결

- VM이 재시작되지 않으면 Reboot 버튼 옆에 메뉴 버튼을 클릭하고 를 선택합니다.

- 응답하지 않는 VM을 종료하려면 마스킹할 수 없는 인터럽트를 보낼 수도 있습니다.

6.2.3. 웹 콘솔을 사용하여 마스킹할 수 없는 인터럽트를 VM에 전송

마스킹할 수 없는 인터럽트(NMI)를 전송하면 실행 중인 VM(가상 머신)이 응답하지 않거나 종료될 수 있습니다. 예를 들어 표준 입력에 응답하지 않는 VM에 Ctrl+Alt+Del NMI를 보낼 수 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

- 인터페이스에서 NMI를 보낼 VM 행을 찾습니다.

행 오른쪽에 있는 메뉴 버튼을 클릭합니다

작업의 드롭다운 메뉴가 표시됩니다.

드롭다운 메뉴에서 를 클릭합니다.

NMI가 VM으로 전송됩니다.

7장. 가상 머신 삭제

RHEL 9에서 가상 머신을 삭제하려면 명령줄 인터페이스 또는 웹 콘솔 GUI 를 사용합니다.

7.1. 명령줄 인터페이스를 사용하여 가상 머신 삭제

VM(가상 머신)을 삭제하려면 명령줄을 사용하여 호스트에서 XML 구성 및 관련 스토리지 파일을 제거할 수 있습니다. 아래 절차를 따르십시오.

사전 요구 사항

- VM에서 중요한 데이터를 백업합니다.

- VM을 종료합니다.

- 다른 VM에서 동일한 연결된 스토리지를 사용하지 않는지 확인합니다.

프로세스

virsh undefine유틸리티를 사용합니다.예를 들어 다음 명령은 guest1 VM, 연결된 스토리지 볼륨, 비휘발성 RAM(있는 경우)을 제거합니다.

# virsh undefine guest1 --remove-all-storage --nvram Domain 'guest1' has been undefined Volume 'vda'(/home/images/guest1.qcow2) removed.

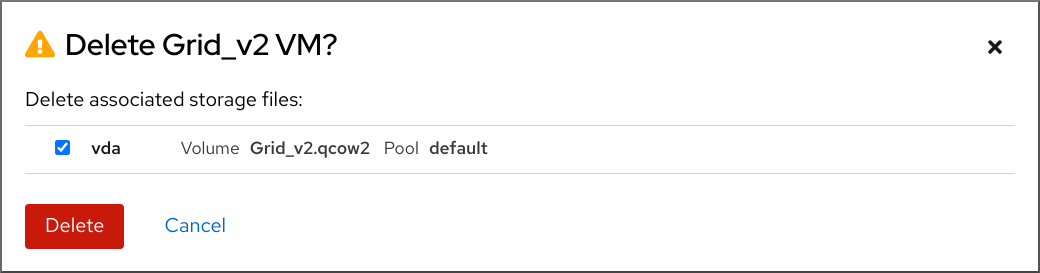

7.2. 웹 콘솔을 사용하여 가상 머신 삭제

RHEL 9 웹 콘솔이 연결된 호스트에서 VM(가상 머신) 및 관련 스토리지 파일을 삭제하려면 다음 절차를 따르십시오.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

- VM에서 중요한 데이터를 백업합니다.

- 다른 VM에서 동일한 연결된 스토리지를 사용하지 않는지 확인합니다.

- 선택 사항: VM을 종료합니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

인터페이스에서 삭제할 VM 메뉴 버튼을 클릭합니다.

다양한 VM 작업에 대한 제어가 포함된 드롭다운 메뉴가 표시됩니다.

를 클릭합니다.

확인 대화 상자가 나타납니다.

- 선택 사항: VM과 연결된 스토리지 파일 전체 또는 일부를 삭제하려면 삭제하려는 스토리지 파일 옆에 있는 확인란을 선택합니다.

를 클릭합니다.

VM 및 선택한 스토리지 파일이 삭제됩니다.

8장. 웹 콘솔에서 가상 머신 관리

RHEL 9 호스트의 그래픽 인터페이스에서 가상 머신을 관리하려면 RHEL 9 웹 콘솔에서 가상 머신 창을 사용할 수 있습니다.

8.1. 웹 콘솔을 사용하여 가상 머신 관리 개요

RHEL 9 웹 콘솔은 시스템 관리를 위한 웹 기반 인터페이스입니다. 해당 기능 중 하나로 웹 콘솔은 호스트 시스템에서 VM(가상 시스템)의 그래픽 보기를 제공하므로 이러한 VM을 생성, 액세스 및 구성할 수 있습니다.

웹 콘솔을 사용하여 RHEL 9에서 VM을 관리하려면 먼저 가상화용 웹 콘솔 플러그인을 설치해야 합니다.

다음 단계

- 웹 콘솔에서 VM 관리 활성화에 대한 지침은 가상 머신을 관리하기 위해 웹 콘솔 설정을 참조하십시오.

- 웹 콘솔에서 제공하는 VM 관리 작업의 포괄적인 목록은 웹 콘솔에서 사용할 수 있는 가상 머신 관리 기능을 참조하십시오.

8.2. 가상 머신을 관리하도록 웹 콘솔 설정

RHEL 9 웹 콘솔을 사용하여 VM(가상 머신)을 관리하기 전에 호스트에 웹 콘솔 가상 머신 플러그인을 설치해야 합니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

프로세스

cockpit-machines플러그인을 설치합니다.# dnf install cockpit-machines

검증

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

설치에 성공하면 웹 콘솔 사이드 메뉴에 가 표시됩니다.

8.3. 웹 콘솔을 사용하여 가상 머신 이름 변경

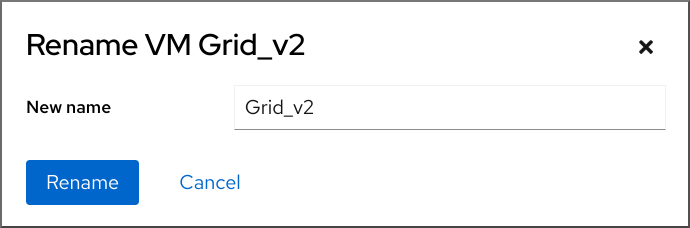

이름 충돌을 방지하거나 사용 사례에 따라 새 고유한 이름을 할당하려면 기존 VM(가상 머신)의 이름을 변경해야 할 수 있습니다. VM의 이름을 변경하려면 RHEL 웹 콘솔을 사용할 수 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

- VM이 종료되었습니다.

프로세스

인터페이스에서 이름을 변경하려는 VM 메뉴 버튼 Cryostat를 클릭합니다.

다양한 VM 작업에 대한 제어가 포함된 드롭다운 메뉴가 표시됩니다.

을 클릭합니다.

Rename a VM (VM 이름 변경) 대화 상자가 나타납니다.

- 새 이름 필드에 VM의 이름을 입력합니다.

- 을 클릭합니다.

검증

- 인터페이스에 새 VM 이름이 표시되는지 확인합니다.

8.4. 웹 콘솔에서 사용 가능한 가상 머신 관리 기능

RHEL 9 웹 콘솔을 사용하면 다음 작업을 수행하여 시스템의 VM(가상 머신)을 관리할 수 있습니다.

| Task | 자세한 내용은 다음을 참조하십시오. |

|---|---|

| VM 생성 및 게스트 운영 체제로 설치 | |

| VM 삭제 | |

| VM을 시작, 종료, 다시 시작 | |

| 다양한 콘솔을 사용하여 VM에 연결 및 상호 작용 | |

| VM에 대한 다양한 정보 보기 | |

| VM에 할당된 호스트 메모리 조정 | |

| VM의 네트워크 연결 관리 | |

| 호스트에서 사용 가능한 VM 스토리지를 관리하고 가상 디스크를 VM에 연결 | |

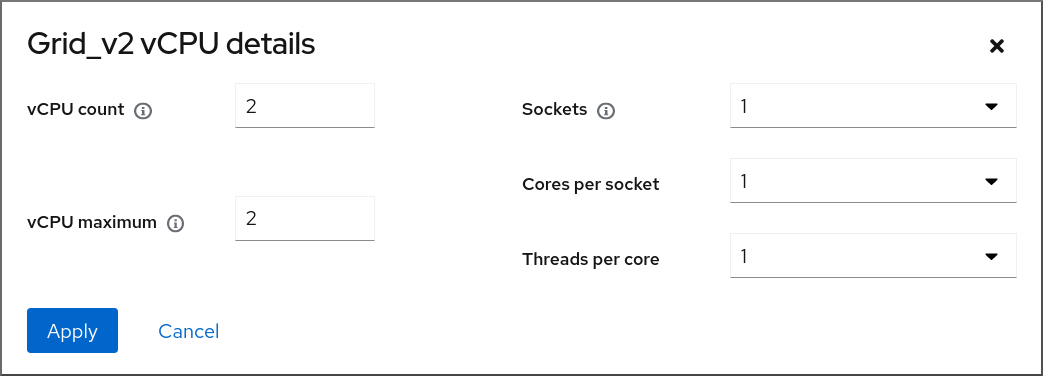

| VM의 가상 CPU 설정 구성 | |

| VM 실시간 마이그레이션 | |

| 호스트 장치 관리 | |

| 가상 광 드라이브 관리 | |

| 워치독 장치 연결 |

9장. 가상 머신에 대한 정보 보기

RHEL 9에서 가상화 배포의 모든 측면을 조정하거나 문제를 해결해야 하는 경우 일반적으로 수행해야 하는 첫 번째 단계는 VM(가상 머신)의 현재 상태 및 구성에 대한 정보를 확인하는 것입니다. 이렇게 하려면 명령줄 인터페이스 또는 웹 콘솔을 사용할 수 있습니다. VM의 XML 구성에서 정보를 볼 수도 있습니다.

9.1. 명령줄 인터페이스를 사용하여 가상 머신 정보 보기

호스트 및 해당 구성에서 VM(가상 머신)에 대한 정보를 검색하려면 다음 명령 중 하나 이상을 사용합니다.

프로세스

호스트의 VM 목록을 가져오려면 다음을 수행합니다.

# virsh list --all Id Name State ---------------------------------- 1 testguest1 running - testguest2 shut off - testguest3 shut off - testguest4 shut off특정 VM에 대한 기본 정보를 얻으려면 다음을 수행합니다.

# virsh dominfo testguest1 Id: 1 Name: testguest1 UUID: a973666f-2f6e-415a-8949-75a7a98569e1 OS Type: hvm State: running CPU(s): 2 CPU time: 188.3s Max memory: 4194304 KiB Used memory: 4194304 KiB Persistent: yes Autostart: disable Managed save: no Security model: selinux Security DOI: 0 Security label: system_u:system_r:svirt_t:s0:c486,c538 (enforcing)특정 VM의 전체 XML 구성을 가져오려면 다음을 수행합니다.

# virsh dumpxml testguest2 <domain type='kvm' id='1'> <name>testguest2</name> <uuid>a973434f-2f6e-4ěša-8949-76a7a98569e1</uuid> <metadata> [...]VM의 XML 구성에 대한 주석이 있는 예제는 샘플 가상 머신 XML 구성을 참조하십시오.

VM의 디스크 및 기타 블록 장치에 대한 정보는 다음과 같습니다.

# virsh domblklist testguest3 Target Source --------------------------------------------------------------- vda /var/lib/libvirt/images/testguest3.qcow2 sda - sdb /home/username/Downloads/virt-p2v-1.36.10-1.el7.isoVM의 스토리지 관리에 대한 자세한 내용은 가상 머신의 스토리지 관리를 참조하십시오.

VM의 파일 시스템 및 마운트 지점에 대한 정보를 얻으려면 다음을 수행합니다.

# virsh domfsinfo testguest3 Mountpoint Name Type Target ------------------------------------ / dm-0 xfs /boot vda1 xfs

특정 VM의 vCPU에 대한 자세한 정보를 얻으려면 다음을 수행합니다.

# virsh vcpuinfo testguest4 VCPU: 0 CPU: 3 State: running CPU time: 103.1s CPU Affinity: yyyy VCPU: 1 CPU: 0 State: running CPU time: 88.6s CPU Affinity: yyyyVM에서 vCPU를 구성하고 최적화하려면 가상 머신 CPU 성능 최적화를 참조하십시오.

호스트의 모든 가상 네트워크 인터페이스를 나열하려면 다음을 수행합니다.

# virsh net-list --all Name State Autostart Persistent --------------------------------------------- default active yes yes labnet active yes yes특정 인터페이스에 대한 자세한 내용은 다음을 수행합니다.

# virsh net-info default Name: default UUID: c699f9f6-9202-4ca8-91d0-6b8cb9024116 Active: yes Persistent: yes Autostart: yes Bridge: virbr0네트워크 인터페이스, VM 네트워크 및 구성 지침에 대한 자세한 내용은 가상 머신 네트워크 연결 구성을 참조하십시오.

- 호스트에서 스토리지 풀 및 스토리지 볼륨에 대한 정보를 보는 방법에 대한 자세한 내용은 CLI를 사용하여 가상 머신 스토리지 정보 보기를 참조하십시오.

9.2. 웹 콘솔을 사용하여 가상 머신 정보 보기

RHEL 9 웹 콘솔을 사용하면 웹 콘솔 세션이 액세스할 수 있는 모든 VM 및 스토리지 풀에 대한 정보를 볼 수 있습니다.

웹 콘솔 세션이 연결된 선택한 VM에 대한 정보를 볼 수 있습니다. 여기에는 해당 디스크,가상 네트워크 인터페이스 및 리소스 사용량 에 대한 정보가 포함됩니다.

9.2.1. 웹 콘솔에서 가상화 개요 보기

웹 콘솔을 사용하면 사용 가능한 VM(가상 머신), 스토리지 풀 및 네트워크에 대한 요약된 정보가 포함된 가상화 개요에 액세스할 수 있습니다.

사전 요구 사항

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

프로세스

웹 콘솔의 사이드 메뉴에서 를 클릭합니다.

사용 가능한 스토리지 풀, 사용 가능한 네트워크 및 웹 콘솔이 연결된 VM에 대한 정보가 대화 상자가 표시됩니다.

정보에는 다음이 포함됩니다.

- 스토리지 풀 - 웹 콘솔과 해당 상태에서 액세스할 수 있는 활성 또는 비활성 스토리지 풀 수입니다.

- 네트워크 - 웹 콘솔과 해당 상태에서 액세스할 수 있는 활성 또는 비활성 네트워크 수입니다.

- name - VM의 이름입니다.

- connection - libvirt 연결, 시스템 또는 세션의 유형입니다.

- State - VM의 상태입니다.

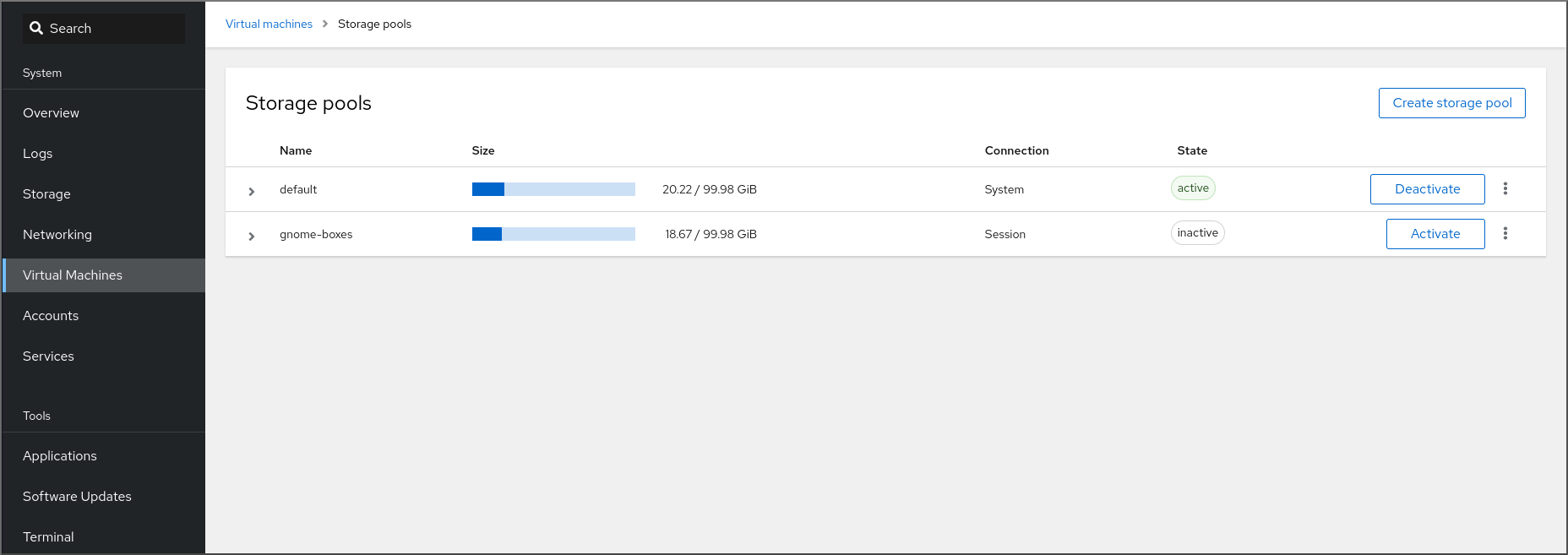

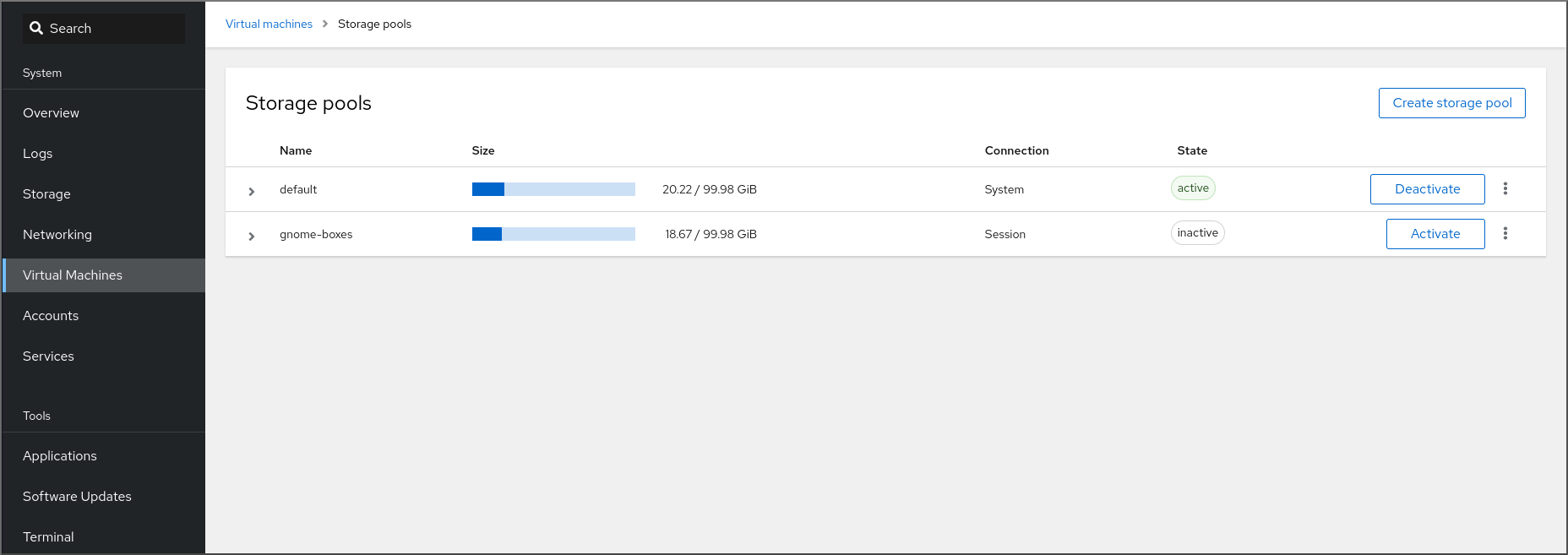

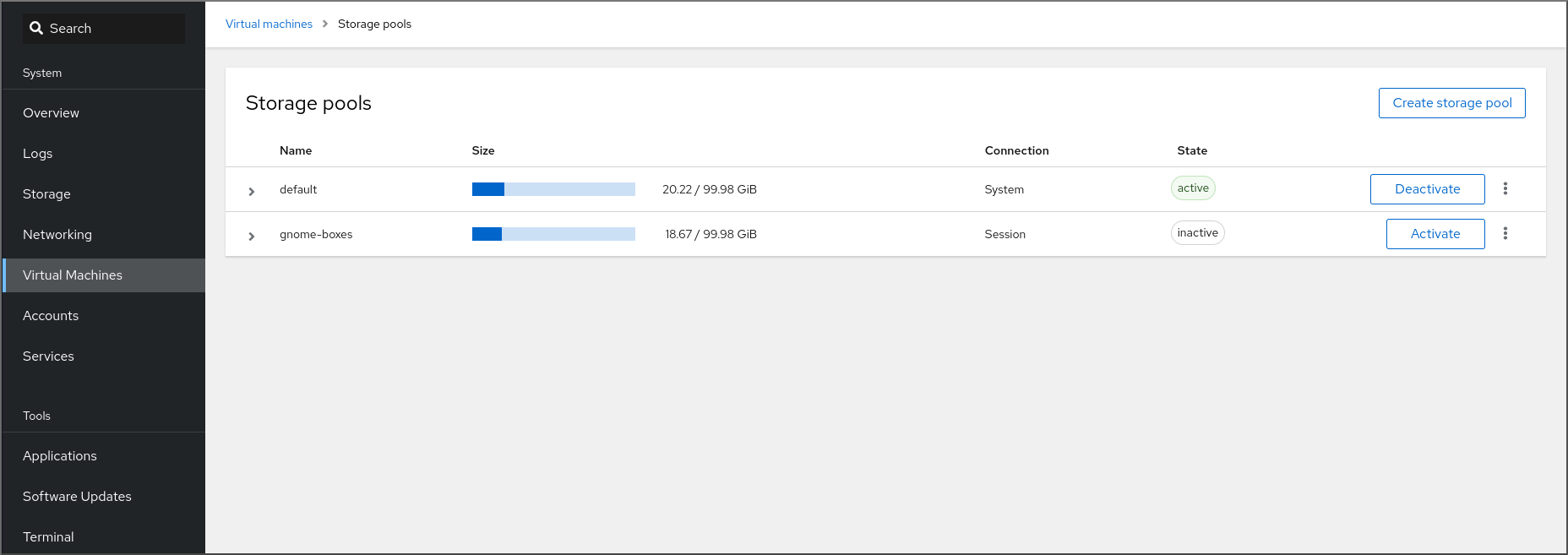

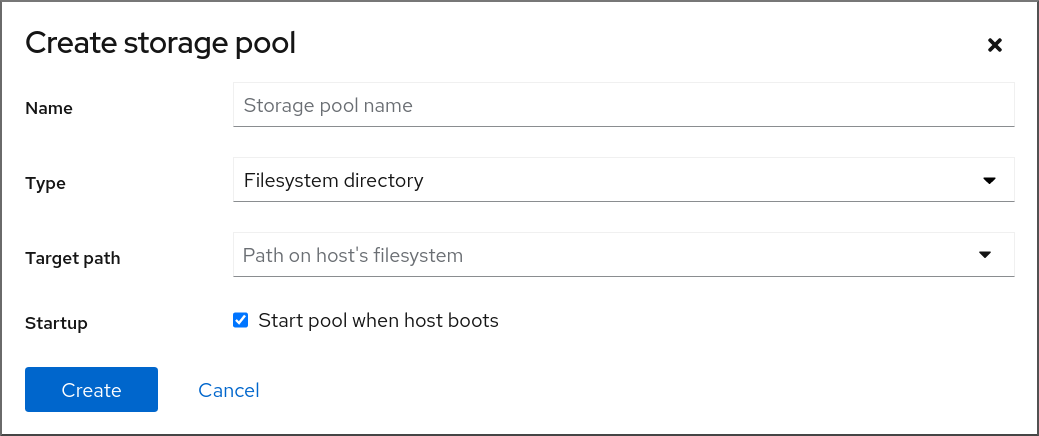

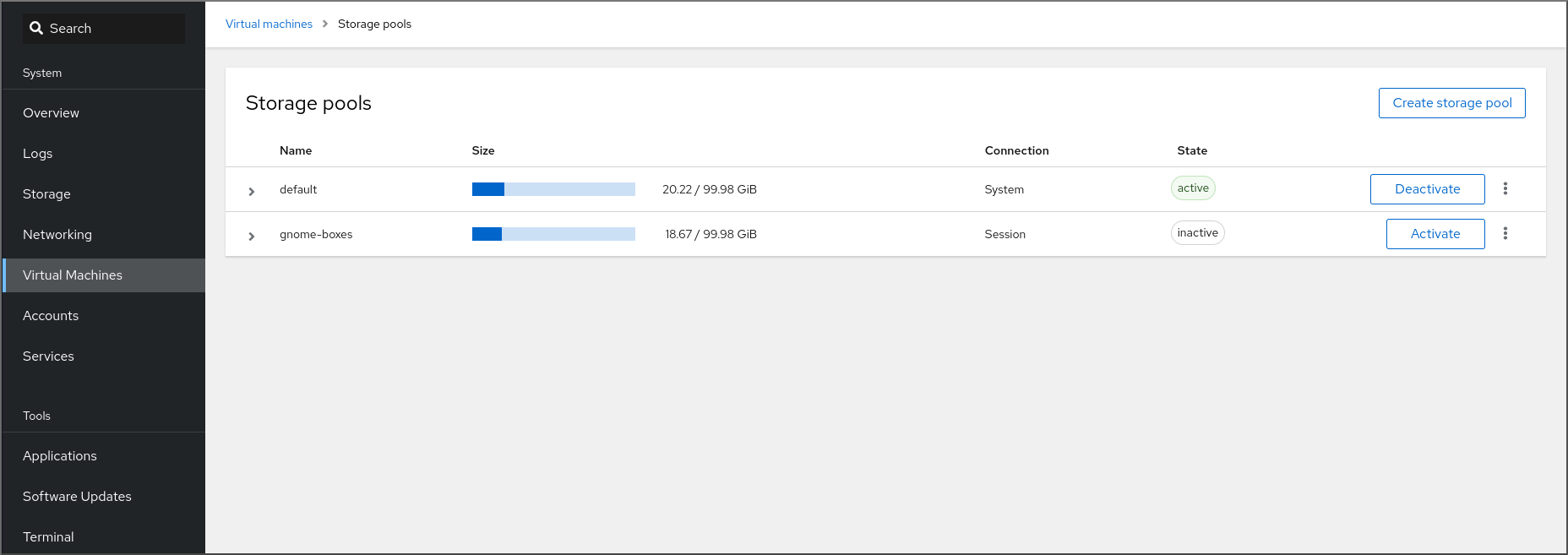

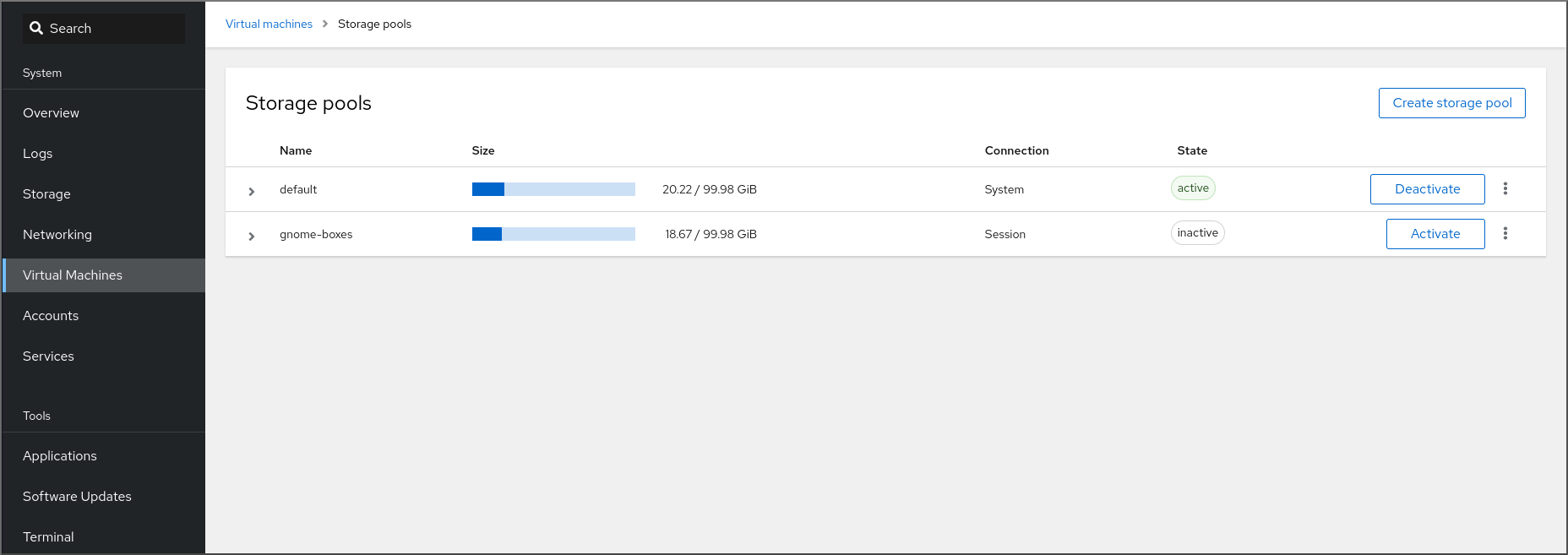

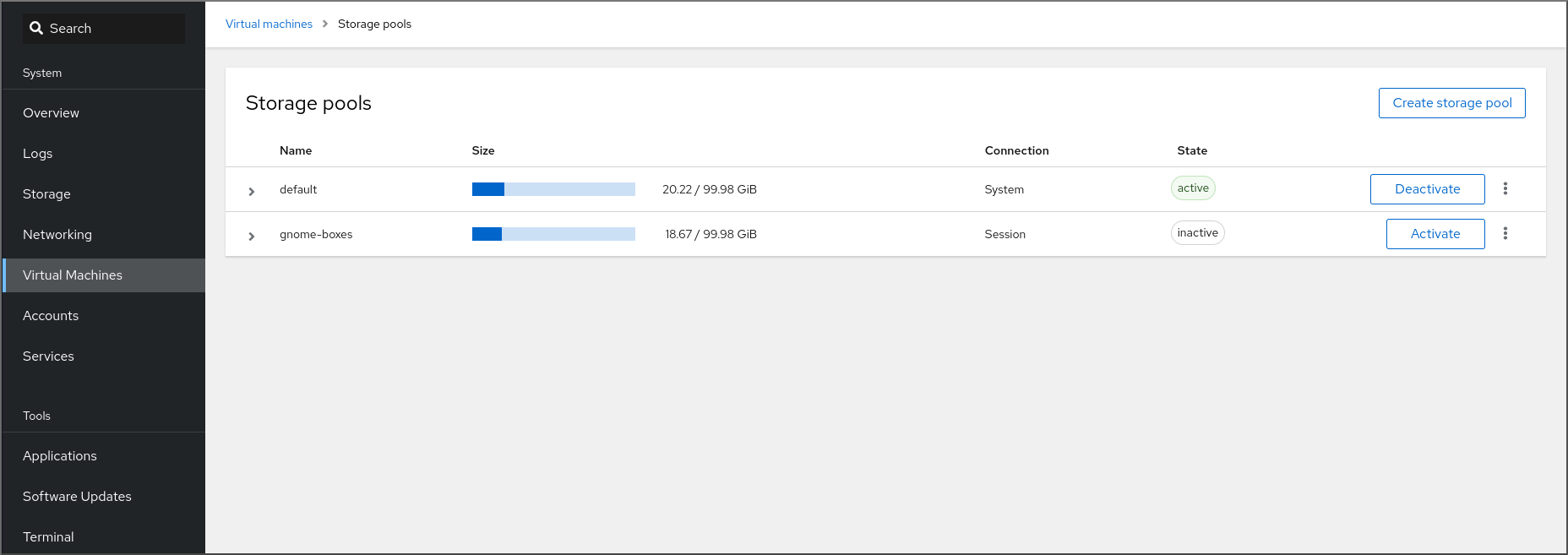

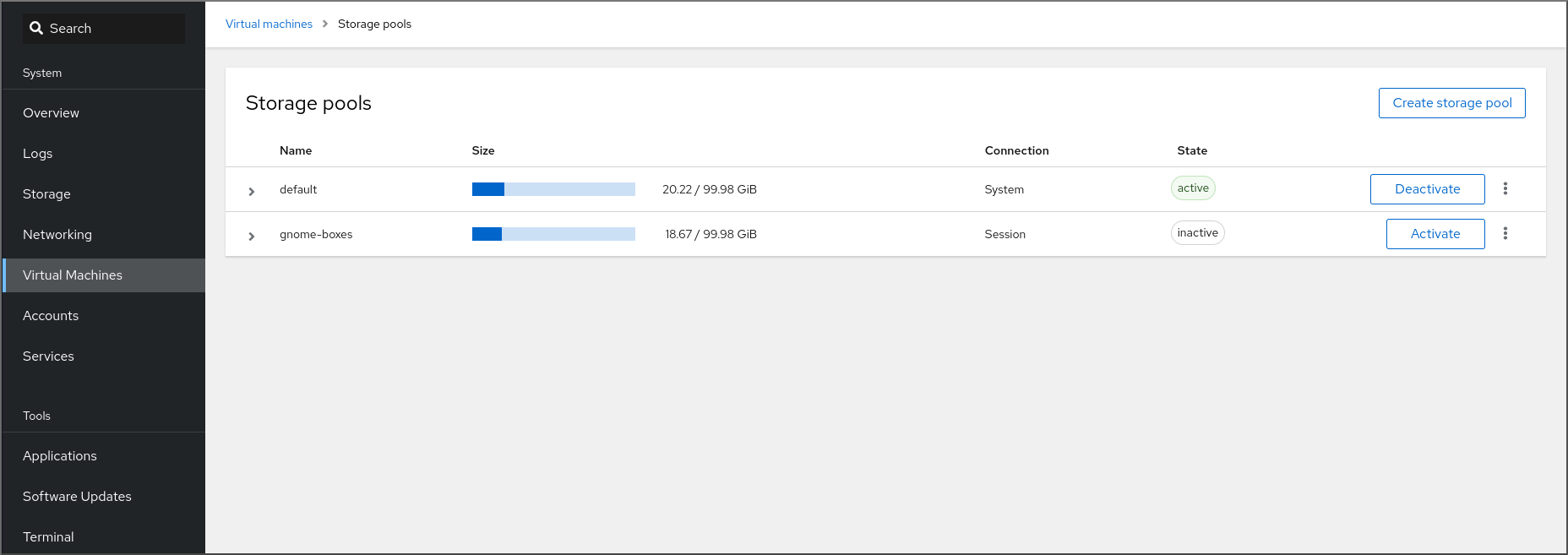

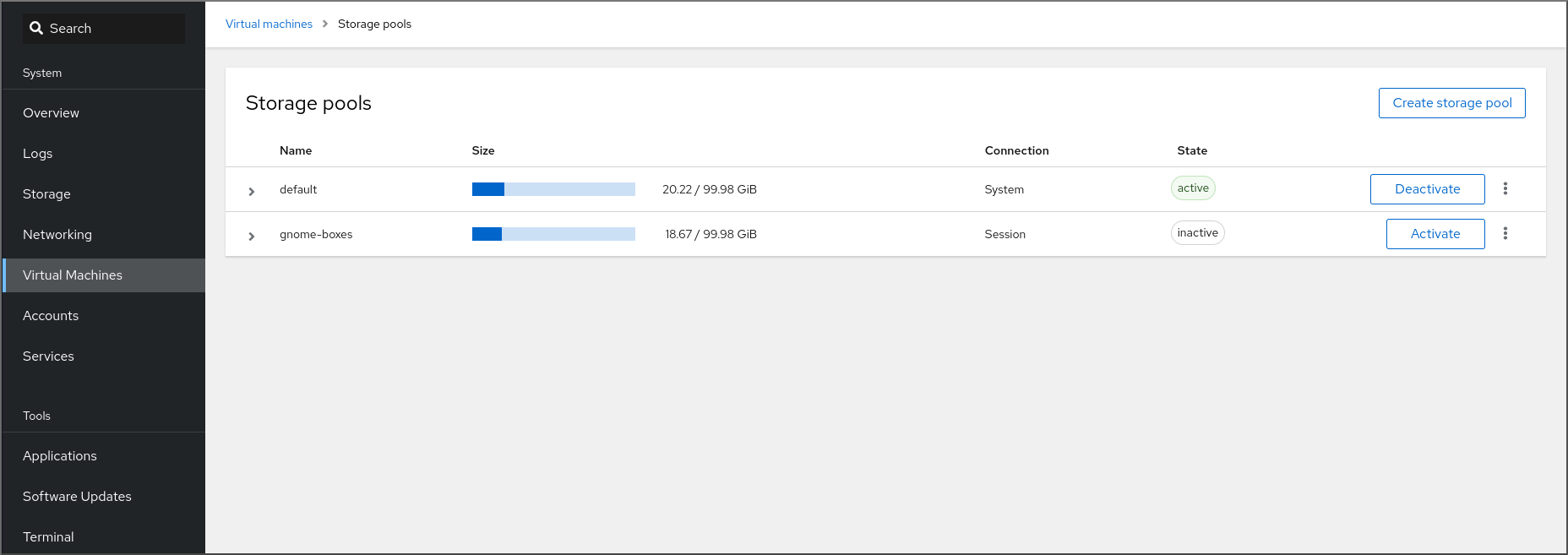

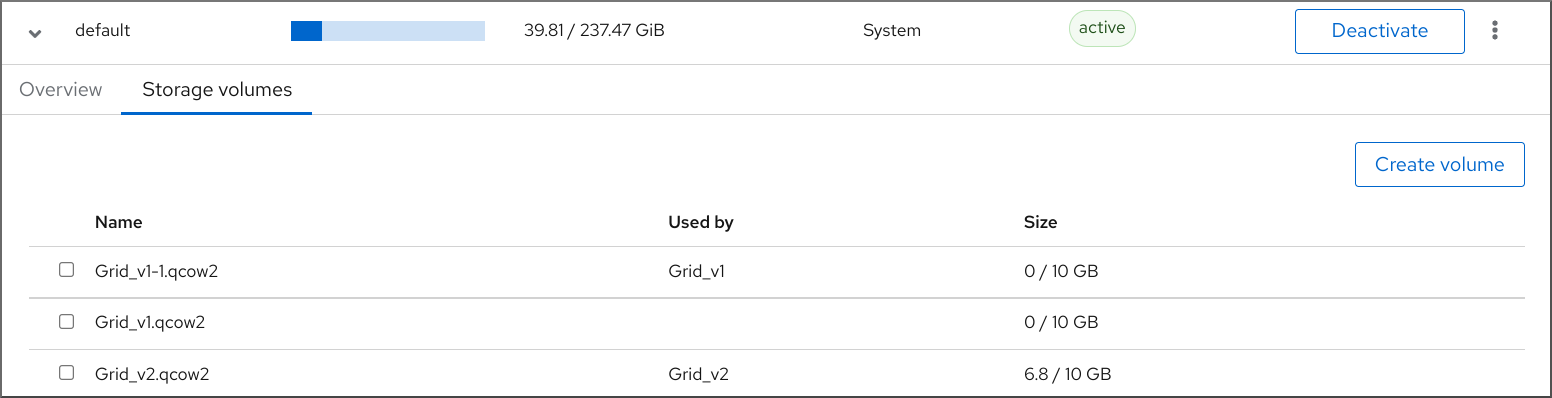

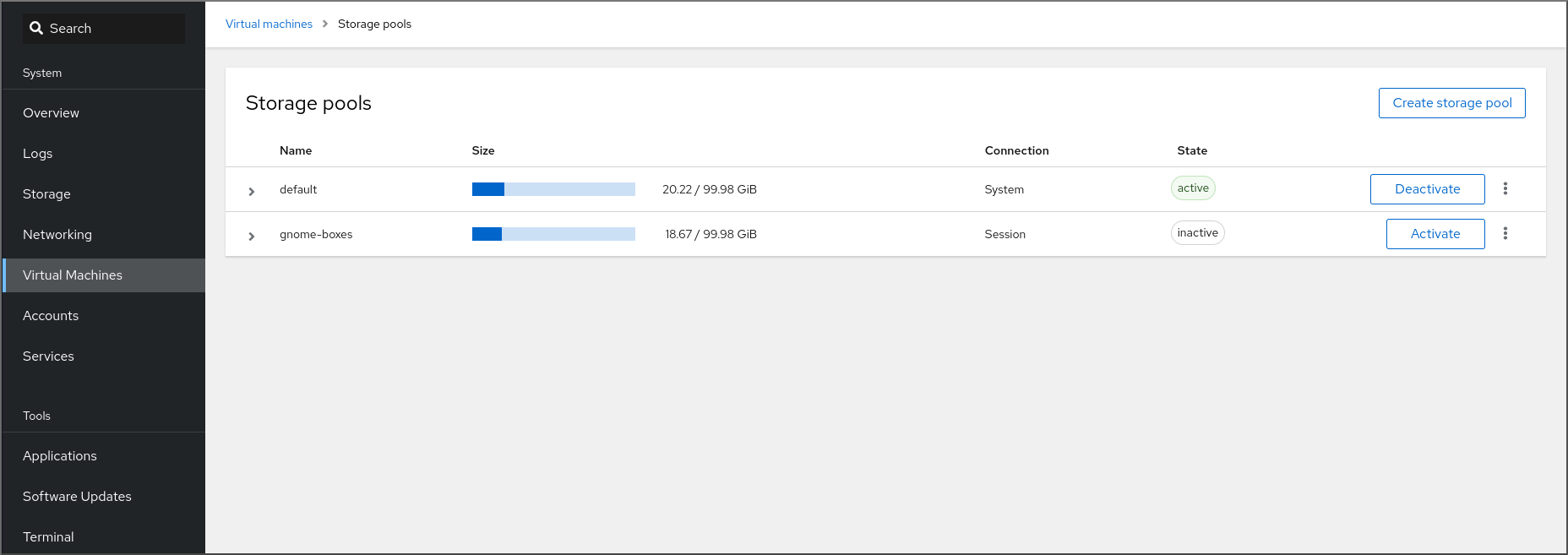

9.2.2. 웹 콘솔을 사용하여 스토리지 풀 정보 보기

웹 콘솔을 사용하면 시스템에서 사용 가능한 스토리지 풀에 대한 자세한 정보를 볼 수 있습니다. 스토리지 풀을 사용하여 가상 머신의 디스크 이미지를 생성할 수 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

인터페이스 상단에 있는 을 클릭합니다.

스토리지 풀 창이 표시되고 구성된 스토리지 풀 목록이 표시됩니다.

정보에는 다음이 포함됩니다.

- name - 스토리지 풀의 이름입니다.

- size - 스토리지 풀의 현재 할당 및 총 용량입니다.

- Connection - 스토리지 풀에 액세스하는 데 사용되는 연결입니다.

- State - 스토리지 풀의 상태입니다.

표시하려는 정보가 있는 스토리지 풀 옆에 있는 화살표를 클릭합니다.

행이 확장되어 선택한 스토리지 풀에 대한 자세한 정보가 포함된 개요 창이 표시됩니다.

정보는 다음을 포함합니다:

- 대상 경로 - 스토리지 풀의 위치입니다.

- Persistent - 스토리지 풀에 영구 구성이 있는지 여부를 나타냅니다.

- autostart - 시스템이 부팅될 때 스토리지 풀이 자동으로 시작되는지 여부를 나타냅니다.

- type - 스토리지 풀의 유형입니다.

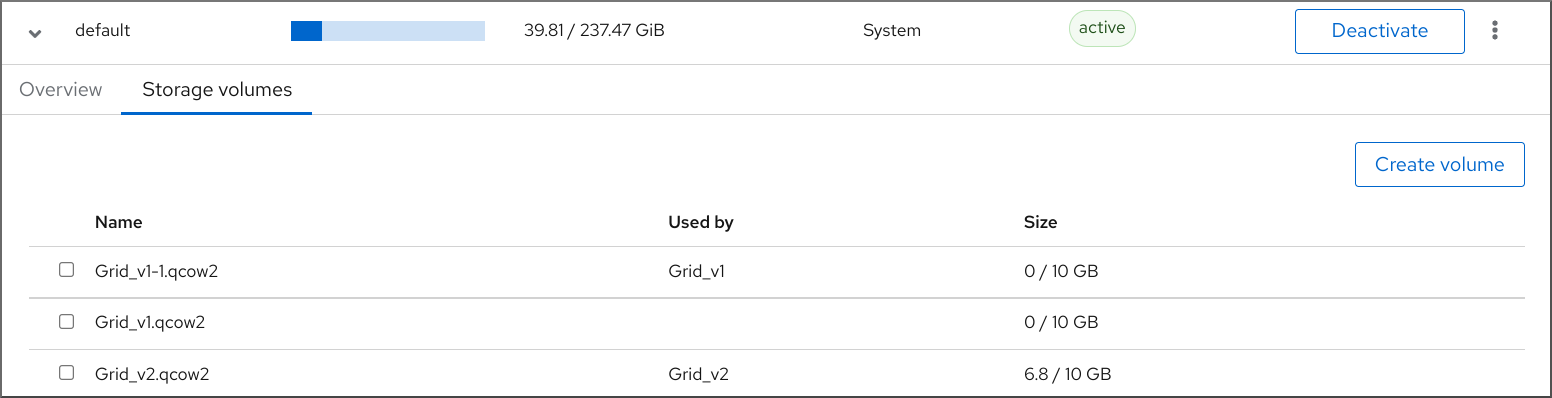

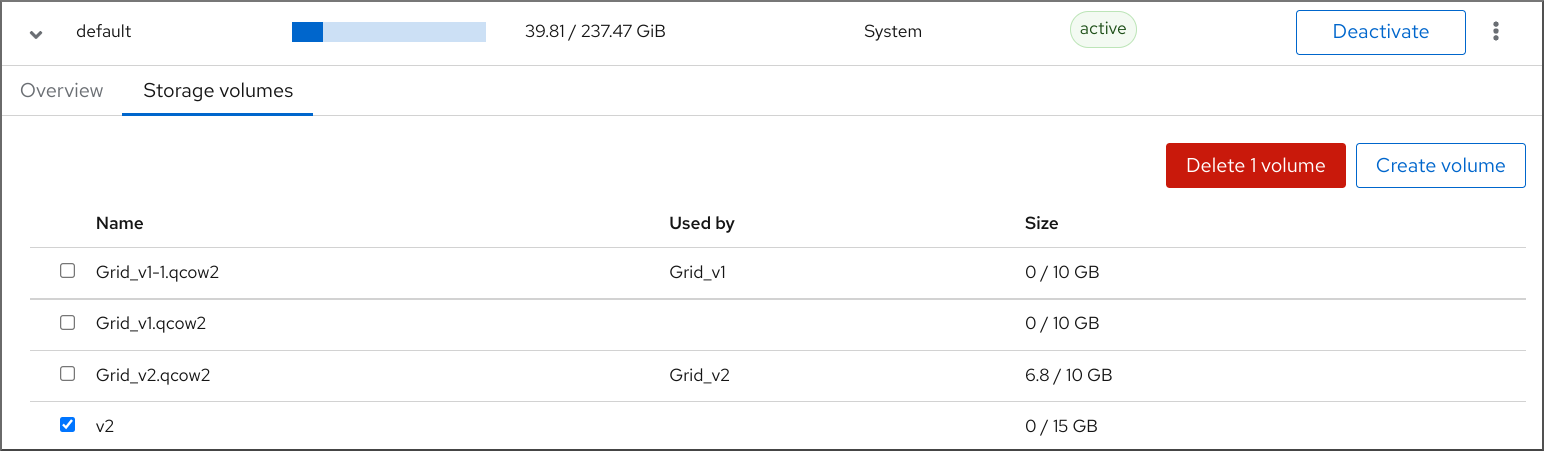

스토리지 풀과 연결된 스토리지 볼륨 목록을 보려면 스토리지 클릭합니다.

스토리지 볼륨 창이 표시되고 구성된 스토리지 볼륨 목록이 표시됩니다.

정보는 다음을 포함합니다:

- name - 스토리지 볼륨의 이름입니다.

- 사용 - 현재 스토리지 볼륨을 사용하고 있는 VM입니다.

- size - 볼륨의 크기입니다.

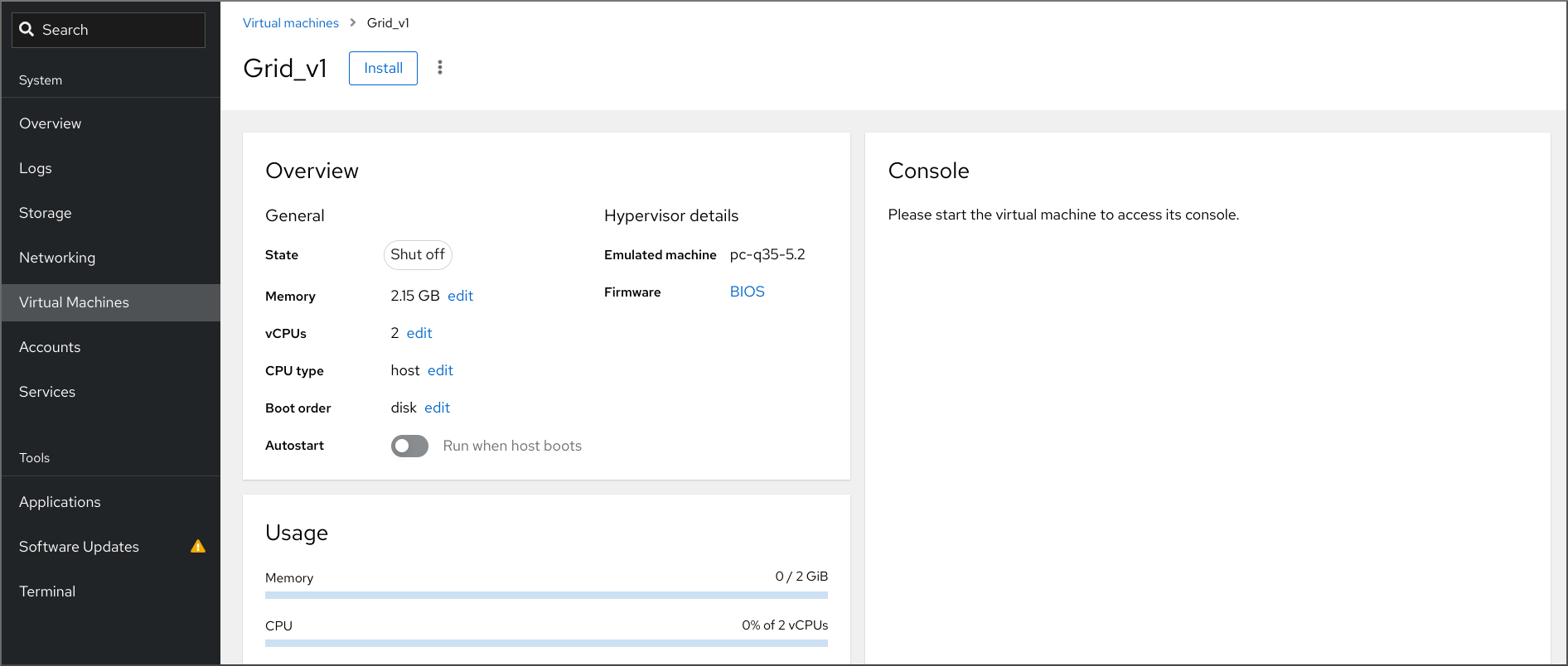

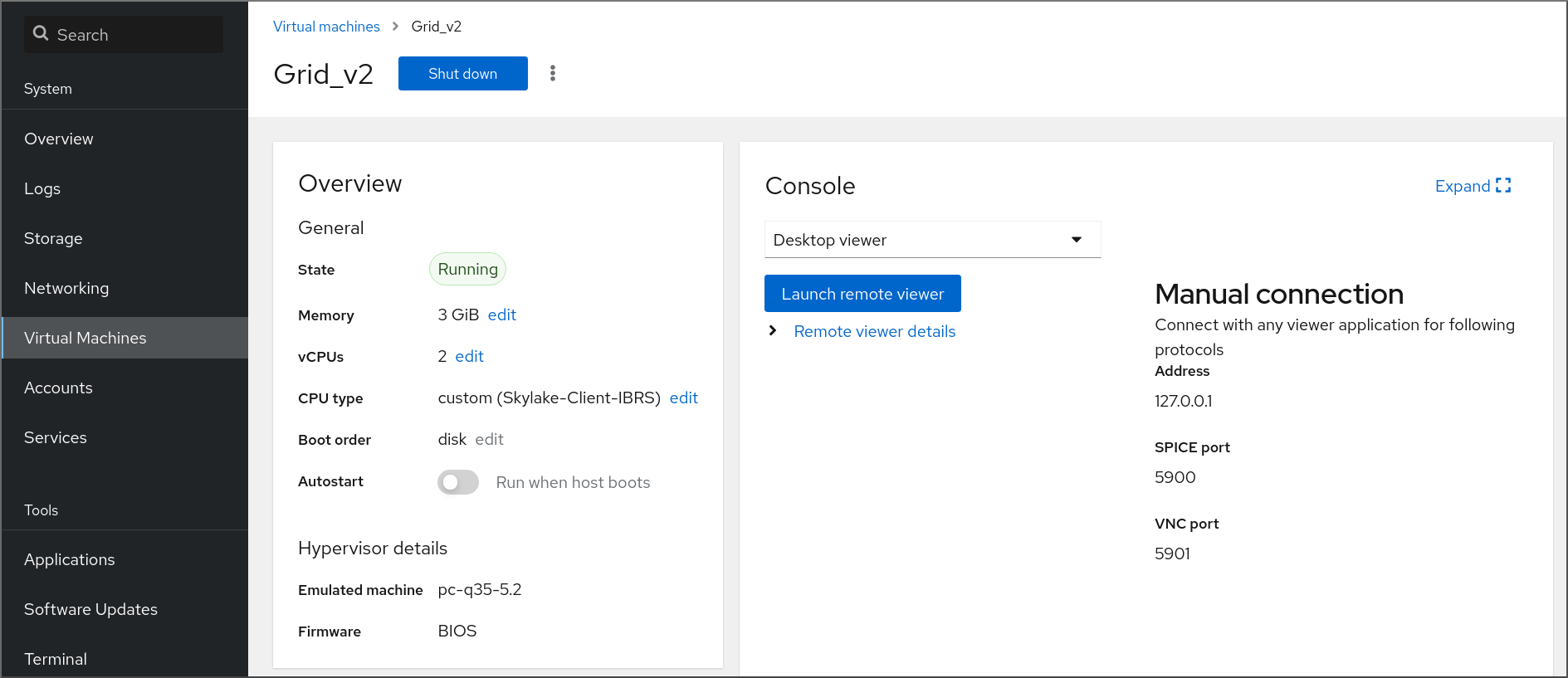

9.2.3. 웹 콘솔에서 기본 가상 머신 정보 보기

웹 콘솔을 사용하면 선택한 VM(가상 머신)에 대한 할당된 리소스 또는 하이퍼바이저 세부 정보와 같은 기본 정보를 볼 수 있습니다.

사전 요구 사항

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

- 웹 콘솔 사이드 메뉴에서 머신을 클릭합니다.

확인할 VM을 클릭합니다.

VM의 그래픽 인터페이스에 액세스하기 위한 선택한 VM 및 콘솔 섹션에 대한 기본 정보가 포함된 개요 섹션이 포함된 새 페이지가 열립니다.

개요 섹션에는 다음과 같은 일반 VM 세부 정보가 포함되어 있습니다.

- State - VM 상태, Running 또는 Shut off입니다.

- memory - VM에 할당된 메모리 양입니다.

- cpu - VM에 대해 구성된 가상 CPU의 수 및 유형입니다.

- 부팅 순서 - VM에 대해 구성된 부팅 순서입니다.

- auto start - VM에 자동 시작이 활성화되었는지 여부입니다.

정보에는 다음 하이퍼바이저 세부 정보도 포함됩니다.

- 에뮬레이션 머신 - VM에서 에뮬레이션한 시스템 유형입니다.

- 펌웨어 - VM의 펌웨어입니다.

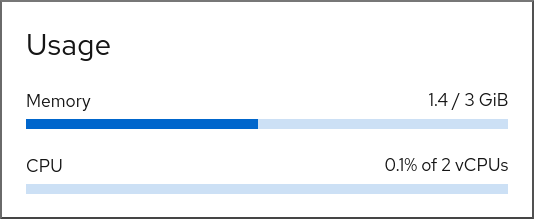

9.2.4. 웹 콘솔에서 가상 머신 리소스 사용량 보기

웹 콘솔을 사용하면 선택한 VM(가상 머신)의 메모리 및 가상 CPU 사용량을 볼 수 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

인터페이스에서 표시하려는 정보가 있는 VM을 클릭합니다.

VM의 그래픽 인터페이스에 액세스하기 위한 선택한 VM 및 콘솔 섹션에 대한 기본 정보가 포함된 개요 섹션이 포함된 새 페이지가 열립니다.

으로 스크롤합니다.

Usage(사용) 섹션에는 VM의 메모리 및 가상 CPU 사용량에 대한 정보가 표시됩니다.

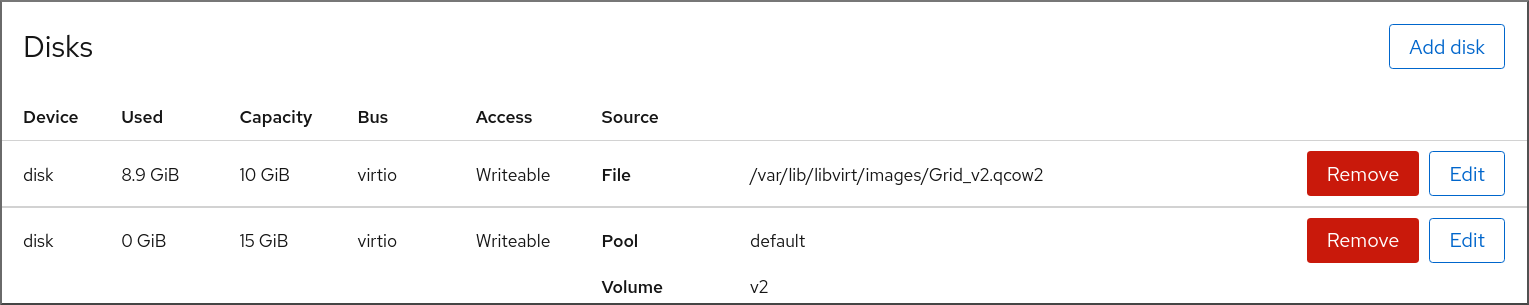

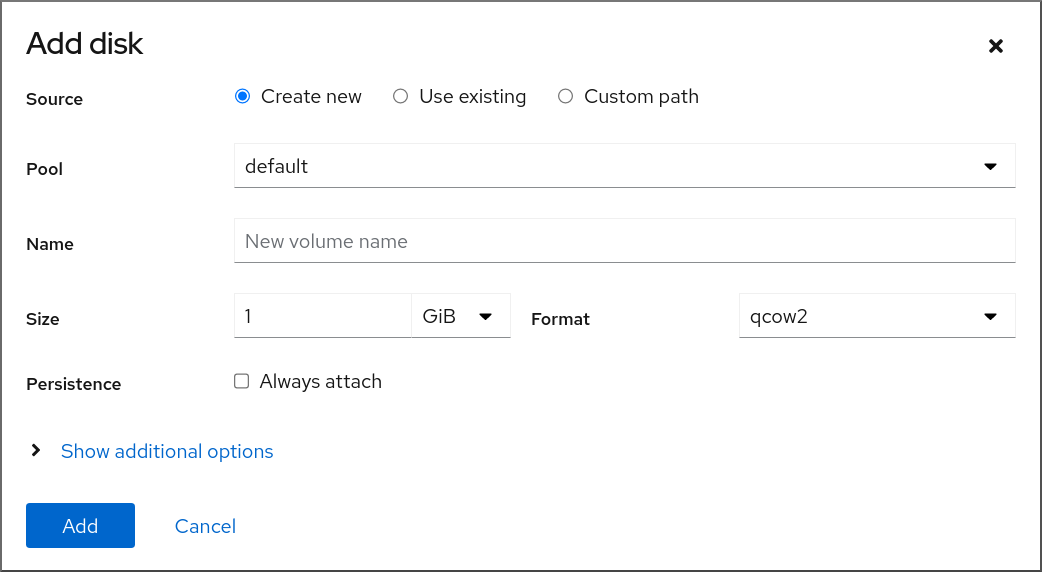

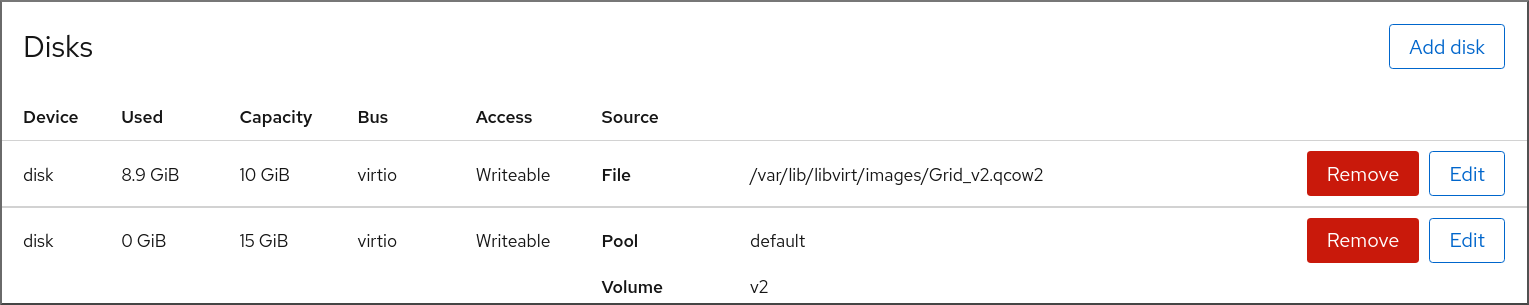

9.2.5. 웹 콘솔에서 가상 머신 디스크 정보 보기

웹 콘솔을 사용하면 선택한 VM(가상 머신)에 할당된 디스크에 대한 자세한 정보를 볼 수 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

확인할 VM을 클릭합니다.

VM의 그래픽 인터페이스에 액세스하기 위한 선택한 VM 및 콘솔 섹션에 대한 기본 정보가 포함된 개요 섹션이 포함된 새 페이지가 열립니다.

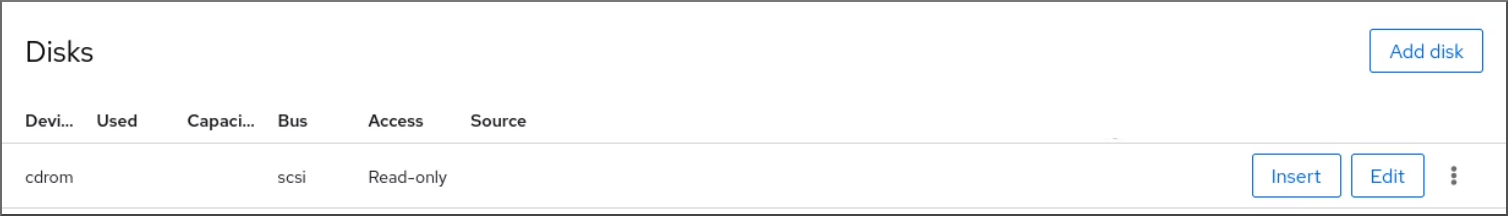

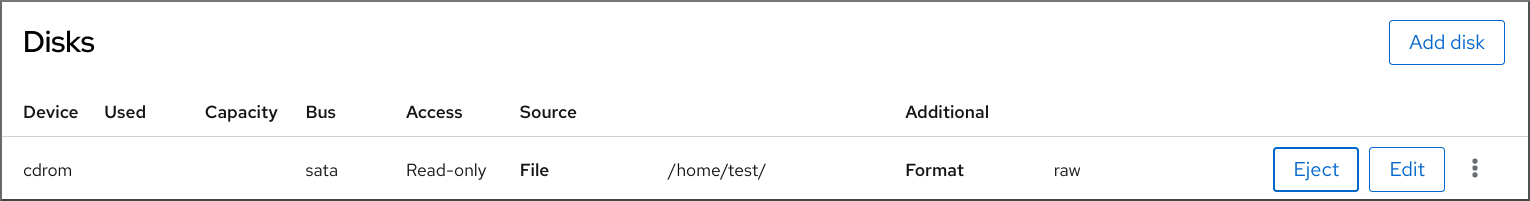

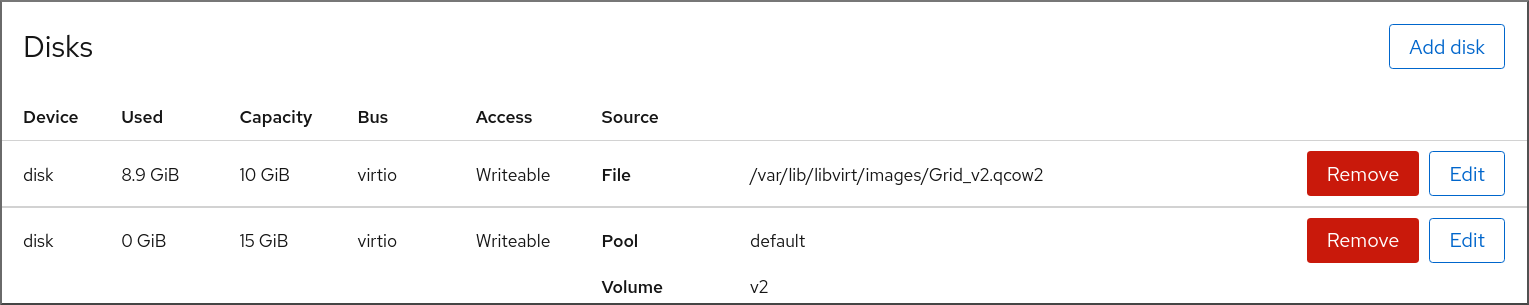

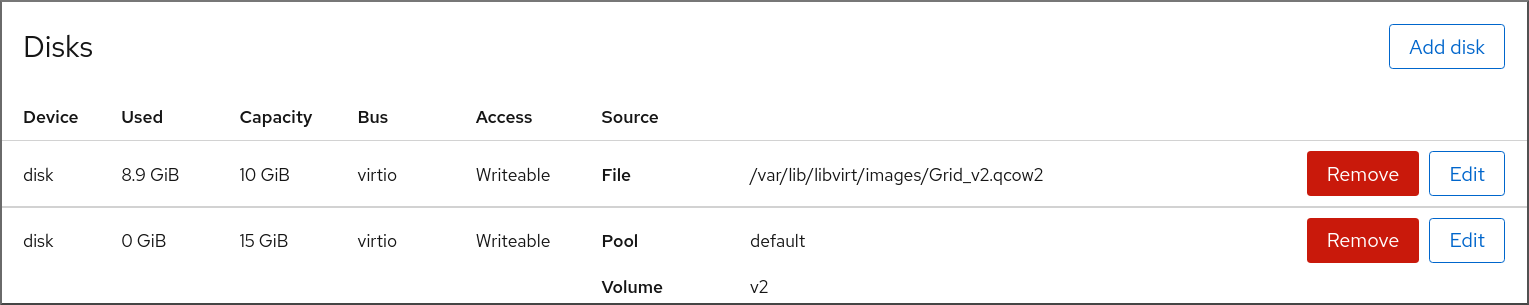

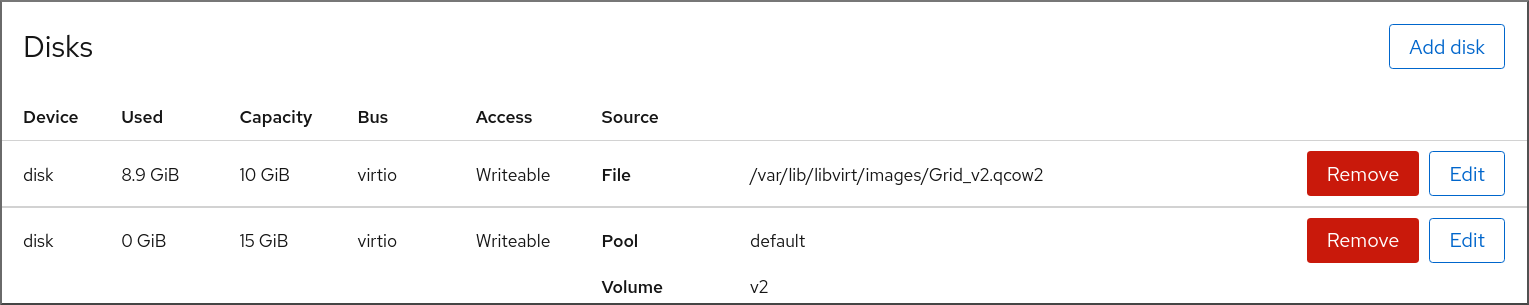

디스크로 스크롤 .

디스크 섹션에는 VM에 할당된 디스크에 대한 정보와 디스크 추가 또는 편집 옵션이 표시됩니다.

정보에는 다음이 포함됩니다.

- Device - 디스크의 장치 유형입니다.

- used - 현재 할당된 디스크 양입니다.

- capacity - 스토리지 볼륨의 최대 크기입니다.

- bus - 에뮬레이션된 디스크 장치의 유형입니다.

-

Access - 디스크를 쓸 수 있는지 또는 읽기 전용인지 여부입니다.

원시디스크의 경우 쓰기 가능 및 공유로 액세스를 설정할 수도 있습니다. - source - 디스크 장치 또는 파일입니다.

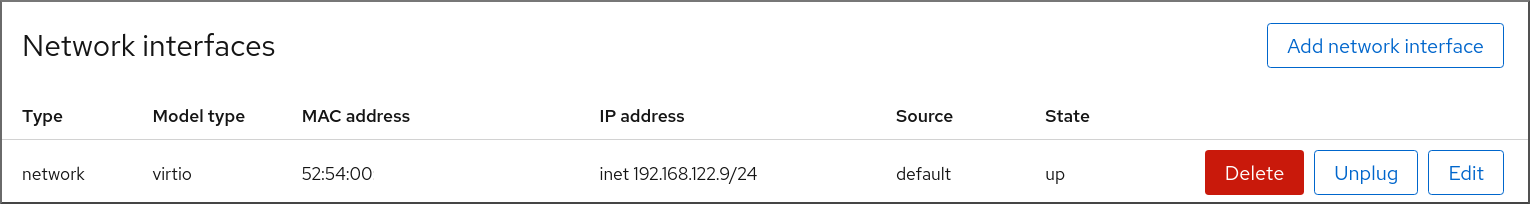

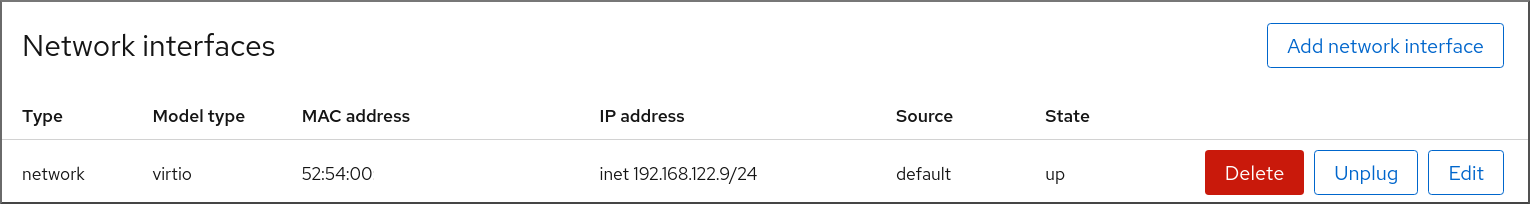

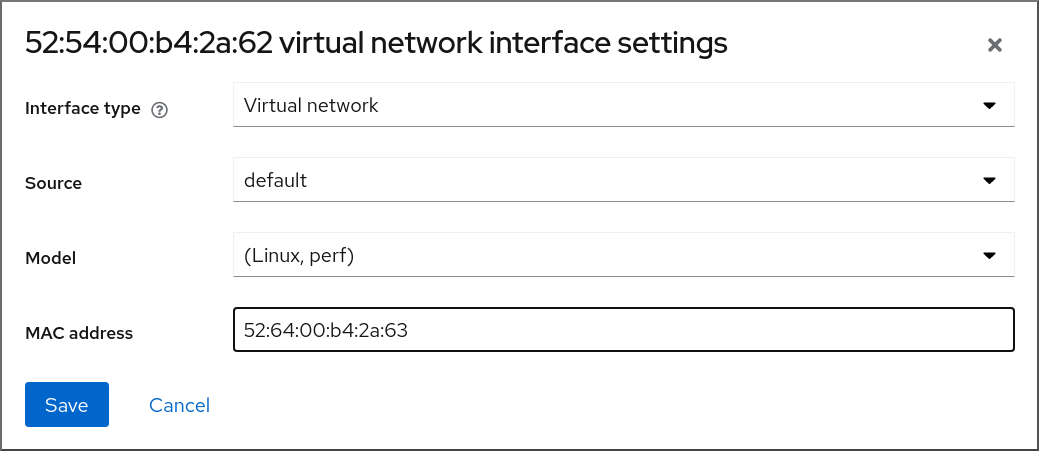

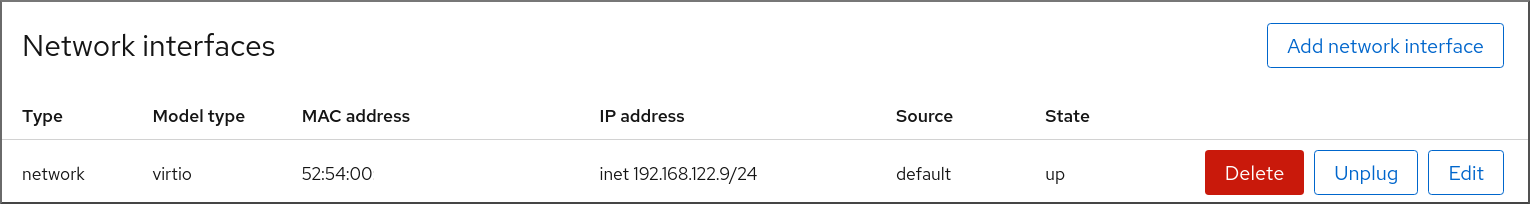

9.2.6. 웹 콘솔에서 가상 네트워크 인터페이스 정보 보기 및 편집

RHEL 9 웹 콘솔을 사용하면 선택한 VM(가상 머신)에서 가상 네트워크 인터페이스를 보고 수정할 수 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

인터페이스에서 표시하려는 정보가 있는 VM을 클릭합니다.

VM의 그래픽 인터페이스에 액세스하기 위한 선택한 VM 및 콘솔 섹션에 대한 기본 정보가 포함된 개요 섹션이 포함된 새 페이지가 열립니다.

.

Networks Interfaces 섹션에는 VM에 대해 구성된 가상 네트워크 인터페이스에 대한 정보와 네트워크 인터페이스 추가,삭제,편집 또는 분리 옵션이 표시됩니다.

정보에는 다음이 포함됩니다.

type - VM의 네트워크 인터페이스 유형입니다. 유형에는 가상 네트워크, bridge to LAN, 직접 연결이 포함됩니다.

참고RHEL 9 이상에서는 일반 이더넷 연결이 지원되지 않습니다.

- 모델 유형 - 가상 네트워크 인터페이스의 모델입니다.

- MAC 주소 - 가상 네트워크 인터페이스의 MAC 주소입니다.

- IP 주소 - 가상 네트워크 인터페이스의 IP 주소입니다.

- Source - 네트워크 인터페이스의 소스입니다. 이는 네트워크 유형에 따라 다릅니다.

- State - 가상 네트워크 인터페이스의 상태입니다.

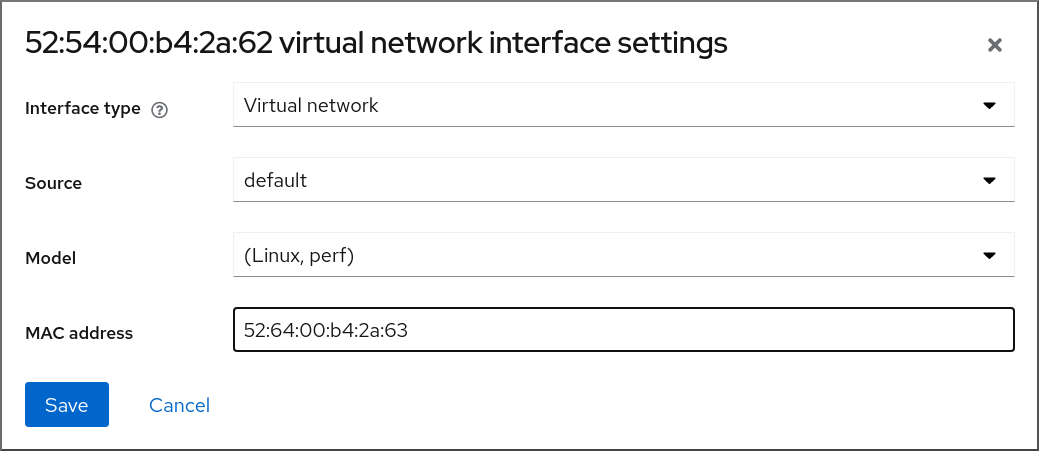

가상 네트워크 인터페이스 설정을 편집하려면 을 클릭합니다. 가상 네트워크 인터페이스 설정 대화 상자가 열립니다.

- 인터페이스 유형, 소스, 모델 또는 MAC 주소를 변경합니다.

을 클릭합니다. 네트워크 인터페이스가 수정되었습니다.

참고가상 네트워크 인터페이스 설정에 대한 변경 사항은 VM을 다시 시작한 후에만 적용됩니다.

또한 MAC 주소는 VM이 종료된 경우에만 수정할 수 있습니다.

9.3. 가상 머신 XML 구성 샘플

VM의 XML 구성( 도메인 XML 이라고도 함)은 VM의 설정 및 구성 요소를 결정합니다. 다음 표에서는 VM(가상 머신)의 샘플 XML 구성 섹션과 내용을 설명합니다.

VM의 XML 구성을 가져오려면 virsh dumpxml 명령 뒤에 VM의 이름을 사용할 수 있습니다.

# virsh dumpxml testguest1| 도메인 XML 섹션 | 설명 |

|---|---|

| 1024MiB가 할당된 Testguest1 이라는 KVM 가상 머신입니다. |

| VM은 단일 가상 CPU(vCPU)로 할당됩니다. vCPU 구성에 대한 자세한 내용은 가상 머신 CPU 성능 최적화를 참조하십시오. |

| 시스템 아키텍처는 AMD64 및 Intel 64 아키텍처로 설정되며 Intel Q35 시스템 유형을 사용하여 기능 호환성을 결정합니다. OS는 하드 디스크 드라이브에서 부팅되도록 설정됩니다. 설치된 OS로 VM을 생성하는 방법에 대한 자세한 내용은 웹 콘솔을 사용하여 가상 머신 생성 및 게스트 운영 체제 설치를 참조하십시오. |

| acpi 및 apic 하이퍼바이저 기능은 비활성화되어 있습니다. |

|

기능 XML의 호스트 CPU 정의( |

| VM의 가상 하드웨어 클록은 UTC 시간대를 사용합니다. 또한 QEMU 하이퍼바이저와 동기화할 세 가지 타이머가 설정됩니다. |

|

VM의 전원을 끄거나 OS가 예기치 않게 종료되면 |

| 이 VM에 대해 S3 및 S4 ACPI 절전 상태가 비활성화되어 있습니다. |

|

VM은 에뮬레이션을 위해

첫 번째 디스크는 호스트에 저장된

두 번째 디스크는 가상화된 CD-ROM이며 논리 장치 이름은 |

|

VM은 단일 컨트롤러를 사용하여 USB 장치를 연결하고 PCI-Express(PCIe) 장치의 루트 컨트롤러를 사용합니다. 또한 가상 장치에 대한 자세한 내용은 가상 장치 유형을 참조하십시오. |

|

네트워크 인터페이스는 네트워크 인터페이스 구성에 대한 자세한 내용은 가상 머신 네트워크 성능 최적화를 참조하십시오. |

|

VM과 상호 작용하는 방법에 대한 자세한 내용은 웹 콘솔을 사용하여 가상 머신 상호 작용을 참조하십시오. |

| VM은 태블릿 입력을 수신하도록 설정된 가상 usb 포트와 마우스 및 키보드 입력을 수신하도록 설정된 가상 ps2 포트를 사용합니다. 이 설정은 자동으로 설정되며 이러한 설정을 변경하는 것은 권장되지 않습니다. |

|

VM은 |

|

VM은 USB 장치를 원격으로 연결하는 데 |

10장. 가상 머신 저장 및 복원

시스템 리소스를 확보하기 위해 해당 시스템에서 실행 중인 VM(가상 머신)을 종료할 수 있습니다. 그러나 VM이 다시 필요한 경우 게스트 운영 체제(OS)를 부팅하고 애플리케이션을 다시 시작해야 하므로 시간이 오래 걸릴 수 있습니다. 이 다운타임을 줄이고 VM 워크로드가 더 빨리 실행되도록 하려면 저장 및 복원 기능을 사용하여 OS 종료 및 부팅 시퀀스를 완전히 방지할 수 있습니다.

이 섹션에서는 VM 저장 및 전체 VM 부팅 없이 동일한 상태로 복원하는 방법에 대한 정보를 제공합니다.

10.1. 가상 머신 저장 및 복원 방법

VM(가상 머신)을 저장하면 메모리와 장치 상태가 호스트의 디스크에 저장되고 VM 프로세스가 즉시 중지됩니다. 실행 중이거나 일시 중지된 상태인 VM을 저장하고 복원 시 VM이 해당 상태로 돌아갑니다.

이 프로세스에서는 디스크 공간을 기준으로 호스트 시스템의 RAM 및 CPU 리소스를 확보하여 호스트 시스템 성능을 향상시킬 수 있습니다. VM이 복원되면 게스트 OS를 부팅할 필요가 없으므로 긴 부팅 기간도 방지할 수 있습니다.

VM을 저장하려면 CLI(명령줄 인터페이스)를 사용할 수 있습니다. 자세한 내용은 명령줄 인터페이스를 사용하여 가상 머신 저장을 참조하십시오.

VM을 복원하려면 CLI 또는 웹 콘솔 GUI 를 사용할 수 있습니다.

스냅샷을 사용하여 VM의 상태를 저장하고 복원할 수도 있습니다. 자세한 내용은 스냅샷을 사용하여 가상 머신 상태 저장 및 복원을 참조하십시오.

10.2. 명령줄 인터페이스를 사용하여 가상 머신 저장

VM(가상 머신) 및 해당 현재 상태를 호스트의 디스크에 저장할 수 있습니다. 예를 들어 다른 용도로 호스트의 리소스를 사용해야 하는 경우 유용합니다. 그런 다음 저장된 VM을 이전 실행 상태로 빠르게 복원할 수 있습니다.

명령줄을 사용하여 VM을 저장하려면 아래 절차를 따르십시오.

사전 요구 사항

- VM 및 해당 구성을 저장할 수 있는 충분한 디스크 공간이 있는지 확인합니다. VM에 사용되는 공간은 해당 VM에 할당된 RAM 크기에 따라 다릅니다.

- VM이 영구적인지 확인합니다.

- 선택 사항: 필요한 경우 VM에서 중요한 데이터를 백업합니다.

프로세스

virsh managedsave유틸리티를 사용합니다.예를 들어 다음 명령은 demo-guest1 VM을 중지하고 구성을 저장합니다.

# virsh managedsave demo-guest1 Domain 'demo-guest1' saved by libvirt저장된 VM 파일은 기본적으로 /var/lib/libvirt/qemu/save 디렉터리에 demo-guest1.save 로 있습니다.

다음에 VM이 시작되면 위의 파일에서 저장된 상태를 자동으로 복원합니다.

검증

저장 공간이 활성화된 VM을 나열합니다. 다음 예에서는 저장된 것으로 나열된 VM의 관리 저장이 활성화되어 있습니다.

# virsh list --managed-save --all Id Name State ---------------------------------------------------- - demo-guest1 saved - demo-guest2 shut off관리 저장 이미지가 있는 VM을 나열하려면 다음을 수행합니다.

# virsh list --with-managed-save --all Id Name State ---------------------------------------------------- - demo-guest1 shut off저장된 VM이 종료된 상태를 나열하려면 명령과 함께

--all또는--inactive옵션을 사용해야 합니다.

문제 해결

- 저장된 VM 파일이 손상되거나 읽을 수 없게 되면 VM을 복원하면 대신 표준 VM 부팅이 시작됩니다.

10.3. 명령줄 인터페이스를 사용하여 가상 머신 시작

CLI(명령줄 인터페이스)를 사용하여 종료 VM(가상 머신)을 시작하거나 저장된 VM을 복원할 수 있습니다. CLI를 사용하면 로컬 및 원격 VM을 모두 시작할 수 있습니다.

사전 요구 사항

- 이미 정의된 비활성 VM입니다.

- VM의 이름입니다.

원격 VM의 경우:

- VM이 있는 호스트의 IP 주소입니다.

- 호스트에 대한 루트 액세스 권한

프로세스

로컬 VM의 경우

virsh start유틸리티를 사용합니다.예를 들어 다음 명령은 demo-guest1 VM을 시작합니다.

# virsh start demo-guest1 Domain 'demo-guest1' started원격 호스트에 있는 VM의 경우 호스트에 대한 QEMU+SSH 연결과 함께

virsh start유틸리티를 사용합니다.예를 들어 다음 명령은 192.0.2.1 호스트에서 demo-guest1 VM을 시작합니다.

# virsh -c qemu+ssh://root@192.0.2.1/system start demo-guest1 root@192.0.2.1's password: Domain 'demo-guest1' started

10.4. 웹 콘솔을 사용하여 가상 머신 시작

VM(가상 머신)이 shut off 상태인 경우 RHEL 9 웹 콘솔을 사용하여 시작할 수 있습니다. 호스트가 시작될 때 자동으로 시작하도록 VM을 구성할 수도 있습니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

- 이미 정의된 비활성 VM입니다.

- VM의 이름입니다.

프로세스

인터페이스에서 시작할 VM을 클릭합니다.

선택한 VM에 대한 자세한 정보와 함께 새 페이지가 열리고 VM 종료 및 삭제를 제어합니다.

클릭합니다.

VM이 시작되고 콘솔 또는 그래픽 출력에 연결할 수 있습니다.

선택 사항: 호스트가 시작될 때 자동으로 시작하도록 VM을 구성하려면 개요 섹션에서

자동 시작확인란을 전환합니다.libvirt에서 관리하지 않는 네트워크 인터페이스를 사용하는 경우 systemd 구성도 추가로 변경해야 합니다. 그렇지 않으면 영향을 받는 VM을 시작하지 못할 수 있습니다. 호스트가 시작될 때 자동으로 가상 머신 시작을 참조하십시오.

11장. 가상 머신 복제

특정 속성 세트를 사용하여 새 VM(가상 머신)을 빠르게 생성하려면 기존 VM을 복제 할 수 있습니다.

복제는 스토리지에 자체 디스크 이미지를 사용하는 새 VM을 생성하지만 대부분의 복제 구성 및 저장된 데이터는 소스 VM과 동일합니다. 이를 통해 각 VM을 개별적으로 최적화할 필요 없이 특정 작업에 최적화된 여러 VM을 준비할 수 있습니다.

11.1. 가상 머신 복제 방법

VM(가상 머신)을 복제하면 소스 VM 및 해당 디스크 이미지의 XML 구성이 복사되고 새 VM의 고유성을 보장하기 위해 구성을 조정합니다. 여기에는 VM의 이름을 변경하고 디스크 이미지 복제를 사용하는지 확인하는 작업이 포함됩니다. 그러나 복제본의 가상 디스크에 저장된 데이터는 소스 VM과 동일합니다.

이 프로세스는 새 VM을 생성하고 게스트 운영 체제로 설치하는 것보다 빠르고 특정 구성 및 콘텐츠를 사용하여 VM을 빠르게 생성하는 데 사용할 수 있습니다.

VM의 복제본을 여러 개 생성하려는 경우 먼저 포함되지 않은 VM 템플릿을 생성합니다.

- 영구 네트워크 MAC 구성과 같은 고유한 설정으로 인해 복제본이 제대로 작동하지 않을 수 있습니다.

- 중요한 데이터(예: SSH 키 및 암호 파일)

자세한 내용은 가상 머신 템플릿 생성 을 참조하십시오.

11.2. 가상 머신 템플릿 생성

올바르게 작동하는 여러 VM(가상 머신) 복제를 생성하려면 SSH 키 또는 영구 네트워크 MAC 구성과 같은 소스 VM에 고유한 정보 및 구성을 제거할 수 있습니다. 이렇게 하면 VM 복제를 쉽고 안전하게 생성하는 데 사용할 수 있는 VM 템플릿이 생성됩니다.

virt-sysprep 유틸리티를 사용하여 VM 템플릿을 생성하거나 요구 사항에 따라 수동으로 생성할 수 있습니다.

11.2.1. virt-sysprep을 사용하여 가상 머신 템플릿 생성

기존 VM(가상 머신)에서 복제 템플릿을 생성하려면 virt-sysprep 유틸리티를 사용할 수 있습니다. 이렇게 하면 특정 네트워크 설정 또는 시스템 등록 메타데이터와 같이 복제본이 잘못 작동할 수 있는 특정 구성이 제거됩니다. 결과적으로 virt-sysprep 을 사용하면 VM의 클론을 보다 효율적으로 생성하고 복제본이 더 안정적으로 작동합니다.

사전 요구 사항

virt-sysprep유틸리티가 포함된guestfs-tools패키지가 호스트에 설치되어 있습니다.# dnf install guestfs-tools- 템플릿으로 설계된 소스 VM이 종료됩니다.

소스 VM의 디스크 이미지가 어디에 있는지 알고 VM의 디스크 이미지 파일의 소유자입니다.

libvirt의 시스템 연결에 생성된 VM의 디스크 이미지는

/var/lib/libvirt/images디렉터리에 있으며 기본적으로 root 사용자가 소유합니다.# ls -la /var/lib/libvirt/images -rw-------. 1 root root 9665380352 Jul 23 14:50 a-really-important-vm.qcow2 -rw-------. 1 root root 8591507456 Jul 26 2017 an-actual-vm-that-i-use.qcow2 -rw-------. 1 root root 8591507456 Jul 26 2017 totally-not-a-fake-vm.qcow2 -rw-------. 1 root root 10739318784 Sep 20 17:57 another-vm-example.qcow2- 선택 사항: 소스 VM 디스크의 중요한 데이터가 백업되었습니다. 소스 VM을 그대로 유지하려면 먼저 복제 한 후 복제본을 템플릿으로 전환합니다.

프로세스

VM의 디스크 이미지의 소유자로 로그인했는지 확인합니다.

# whoami root선택 사항: VM의 디스크 이미지를 복사합니다.

# cp /var/lib/libvirt/images/a-really-important-vm.qcow2 /var/lib/libvirt/images/a-really-important-vm-original.qcow2나중에 VM이 템플릿으로 변환되었는지 확인하는 데 사용됩니다.

다음 명령을 사용하고 /var/lib/libvirt/images/a-really-important-vm.qcow2 를 소스 VM의 디스크 이미지 경로로 바꿉니다.

# virt-sysprep -a /var/lib/libvirt/images/a-really-important-vm.qcow2 [ 0.0] Examining the guest ... [ 7.3] Performing "abrt-data" ... [ 7.3] Performing "backup-files" ... [ 9.6] Performing "bash-history" ... [ 9.6] Performing "blkid-tab" ... [...]

검증

프로세스가 성공했는지 확인하려면 수정된 디스크 이미지를 원본 이미지와 비교합니다. 다음 예제에서는 템플릿을 성공적으로 생성하는 방법을 보여줍니다.

# virt-diff -a /var/lib/libvirt/images/a-really-important-vm-orig.qcow2 -A /var/lib/libvirt/images/a-really-important-vm.qcow2 - - 0644 1001 /etc/group- - - 0000 797 /etc/gshadow- = - 0444 33 /etc/machine-id [...] - - 0600 409 /home/username/.bash_history - d 0700 6 /home/username/.ssh - - 0600 868 /root/.bash_history [...]

11.2.2. 수동으로 가상 머신 템플릿 생성

기존 VM(가상 머신)에서 템플릿을 생성하려면 게스트 VM을 수동으로 재설정하거나 구성 해제하여 복제를 준비할 수 있습니다.

사전 요구 사항

소스 VM의 디스크 이미지 위치를 알고 VM의 디스크 이미지 파일 소유자인지 확인합니다.

libvirt의 시스템 연결에 생성된 VM의 디스크 이미지는 기본적으로

/var/lib/libvirt/images디렉터리에 있으며 root 사용자가 소유합니다.# ls -la /var/lib/libvirt/images -rw-------. 1 root root 9665380352 Jul 23 14:50 a-really-important-vm.qcow2 -rw-------. 1 root root 8591507456 Jul 26 2017 an-actual-vm-that-i-use.qcow2 -rw-------. 1 root root 8591507456 Jul 26 2017 totally-not-a-fake-vm.qcow2 -rw-------. 1 root root 10739318784 Sep 20 17:57 another-vm-example.qcow2- VM이 종료되었는지 확인합니다.

- 선택 사항: VM 디스크의 중요한 데이터가 백업됩니다. 소스 VM을 그대로 유지하려면 먼저 복제 한 후 복제본을 편집하여 템플릿을 생성합니다.

프로세스

복제를 위해 VM을 구성합니다.

- 복제본에 필요한 소프트웨어를 설치합니다.

- 운영 체제에 대해 고유하지 않은 설정을 구성합니다.

- 고유하지 않은 애플리케이션 설정을 구성합니다.

네트워크 구성을 제거합니다.

다음 명령을 사용하여 영구 udev 규칙을 제거합니다.

# rm -f /etc/udev/rules.d/70-persistent-net.rules참고udev 규칙이 제거되지 않으면 첫 번째 NIC의 이름이

eth0대신eth1일 수 있습니다./etc/NetworkManager/system-connections/디렉터리의NMConnection파일에서 고유한 정보를 제거합니다.MAC 주소, IP 주소, DNS, 게이트웨이 및 기타 고유 정보 또는 원하지 않는 설정을 제거합니다.

*ID=ExampleNetwork BOOTPROTO="dhcp" HWADDR="AA:BB:CC:DD:EE:FF" <- REMOVE NM_CONTROLLED="yes" ONBOOT="yes" TYPE="Ethernet" UUID="954bd22c-f96c-4b59-9445-b39dd86ac8ab" <- REMOVE-

/etc/hosts및/etc/resolv.conf파일에서 유사한 고유 정보 및 원하지 않는 설정을 제거합니다.

등록 세부 정보 삭제:

RHN(Red Hat Network)에 등록된 VM의 경우:

# rm /etc/sysconfig/rhn/systemidRHSM(Red Hat Subscription Manager)에 등록된 VM의 경우:

원래 VM을 사용하지 않으려면 다음을 수행합니다.

# subscription-manager unsubscribe --all # subscription-manager unregister # subscription-manager clean원래 VM을 사용하려는 경우:

# subscription-manager clean참고원래 RHSM 프로필은 ID 코드와 함께 포털에 남아 있습니다. 복제 후 VM에서 RHSM 등록을 다시 활성화하려면 다음 명령을 사용합니다.

# subscription-manager register --consumerid=71rd64fx-6216-4409-bf3a-e4b7c7bd8ac9

다른 고유한 세부 정보 제거:

SSH 공개 및 개인 키 쌍을 제거합니다.

# rm -rf /etc/ssh/ssh_host_exampleLVM 장치의 구성을 제거합니다.

# rm /etc/lvm/devices/system.devices- 여러 시스템에서 실행되는 경우 충돌이 발생할 수 있는 기타 애플리케이션별 식별자 또는 구성을 제거합니다.

gnome-initial-setup-done파일을 제거하여 다음 부팅 시 구성 마법사를 실행하도록 VM을 구성합니다.# rm ~/.config/gnome-initial-setup-done참고다음 부팅 시 실행되는 마법사는 VM에서 제거된 구성에 따라 다릅니다. 또한 복제본을 처음 부팅할 때는 호스트 이름을 변경하는 것이 좋습니다.

11.3. 명령줄 인터페이스를 사용하여 가상 머신 복제

테스트의 경우 특정 속성 세트로 새 VM(가상 머신)을 생성하려면 CLI를 사용하여 기존 VM을 복제할 수 있습니다.

사전 요구 사항

- 소스 VM이 종료되었습니다.

- 복제된 디스크 이미지를 저장할 디스크 공간이 충분한지 확인합니다.

- 선택 사항: 여러 VM 복제를 생성할 때 소스 VM에서 고유한 데이터 및 설정을 제거하여 복제된 VM이 제대로 작동하는지 확인합니다. 자세한 내용은 가상 머신 템플릿 생성 을 참조하십시오.

프로세스

환경 및 사용 사례에 적합한 옵션과 함께

virt-clone유틸리티를 사용합니다.샘플 사용 사례

다음 명령은

example-VM-1이라는 로컬 VM을 복제하고example-VM-1-cloneVM을 생성합니다. 또한 원래 VM의 디스크 이미지와 동일한 위치에example-VM-1-clone.qcow2디스크 이미지를 생성하고 할당합니다.# virt-clone --original example-VM-1 --auto-clone Allocating 'example-VM-1-clone.qcow2' | 50.0 GB 00:05:37 Clone 'example-VM-1-clone' created successfully.다음 명령은

example-VM-2라는 VM을 복제하고example-VM-3이라는 로컬 VM을 생성합니다. 이 VM-3은example-VM-2디스크 중 두 개만 사용합니다.# virt-clone --original example-VM-2 --name example-VM-3 --file /var/lib/libvirt/images/disk-1-example-VM-2.qcow2 --file /var/lib/libvirt/images/disk-2-example-VM-2.qcow2 Allocating 'disk-1-example-VM-2-clone.qcow2' | 78.0 GB 00:05:37 Allocating 'disk-2-example-VM-2-clone.qcow2' | 80.0 GB 00:05:37 Clone 'example-VM-3' created successfully.VM을 다른 호스트에 복제하려면 로컬 호스트에서 재정의하지 않고 VM을 마이그레이션합니다. 예를 들어 다음 명령은 이전에 생성된

example-VM-3VM을 로컬 디스크를 포함하여192.0.2.1원격 시스템에 복제합니다.192.0.2.1에 대해 이러한 명령을 실행하려면 root 권한이 필요합니다.# virsh migrate --offline --persistent example-VM-3 qemu+ssh://root@192.0.2.1/system root@192.0.2.1's password: # scp /var/lib/libvirt/images/<disk-1-example-VM-2-clone>.qcow2 root@192.0.2.1/<user@remote_host.com>://var/lib/libvirt/images/ # scp /var/lib/libvirt/images/<disk-2-example-VM-2-clone>.qcow2 root@192.0.2.1/<user@remote_host.com>://var/lib/libvirt/images/

검증

VM이 성공적으로 복제되었으며 제대로 작동하는지 확인하려면 다음을 수행하십시오.

호스트의 VM 목록에 복제본이 추가되었는지 확인합니다.

# virsh list --all Id Name State --------------------------------------- - example-VM-1 shut off - example-VM-1-clone shut off복제본을 시작하고 부팅 여부를 관찰합니다.

# virsh start example-VM-1-clone Domain 'example-VM-1-clone' started

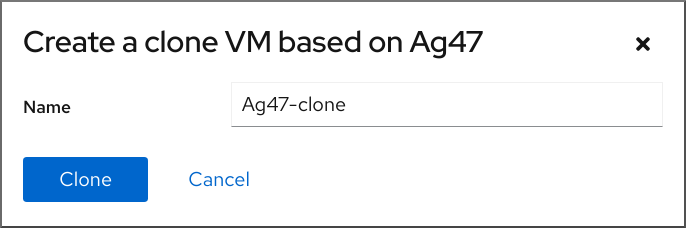

11.4. 웹 콘솔을 사용하여 가상 머신 복제

특정 속성 세트를 사용하여 새 VM(가상 머신)을 생성하려면 웹 콘솔을 사용하여 이전에 구성한 VM을 복제할 수 있습니다.

VM 복제는 해당 VM과 연결된 디스크도 복제합니다.

사전 요구 사항

RHEL 9 웹 콘솔을 설치했습니다.

자세한 내용은 웹 콘솔 설치 및 활성화를 참조하십시오.

- 웹 콘솔 VM 플러그인이 시스템에 설치되어 있습니다.

- 복제하려는 VM이 종료되었는지 확인합니다.

프로세스

RHEL 9 웹 콘솔에 로그인합니다.

자세한 내용은 웹 콘솔에 로그인 을 참조하십시오.

웹 콘솔의 가상 머신 인터페이스에서 복제하려는 의 메뉴 버튼을 클릭합니다.

다양한 VM 작업에 대한 제어가 포함된 드롭다운 메뉴가 표시됩니다.

을 클릭합니다.

Create a clone VM 대화 상자가 나타납니다.

- 선택 사항: VM 복제의 새 이름을 입력합니다.

을 클릭합니다.

소스 VM을 기반으로 새 VM이 생성됩니다.

검증

- 복제된 VM이 호스트에서 사용 가능한 VM 목록에 표시되는지 확인합니다.

12장. 가상 머신 마이그레이션

VM(가상 머신)의 현재 호스트가 적합하지 않거나 더 이상 사용할 수 없거나 호스팅 워크로드를 재배포하려는 경우 VM을 다른 KVM 호스트로 마이그레이션할 수 있습니다.

12.1. 가상 머신의 작동 방식

VM(가상 머신) 마이그레이션의 필수 부분은 VM의 XML 구성을 다른 호스트 머신에 복사하는 것입니다. 마이그레이션된 VM이 종료되지 않은 경우 마이그레이션은 VM의 메모리 및 가상화된 장치의 상태도 대상 호스트 시스템으로 전송합니다. VM이 대상 호스트에서 작동하도록 하려면 VM의 디스크 이미지를 계속 사용할 수 있어야 합니다.

기본적으로 마이그레이션된 VM은 대상 호스트에서 일시적인 것이며 소스 호스트에도 정의되어 있습니다.

실시간 또는 실시간 이 아닌 마이그레이션을 사용하여 실행 중인 VM을 마이그레이션할 수 있습니다. 종료 VM을 마이그레이션하려면 오프라인 마이그레이션을 사용해야 합니다. 자세한 내용은 다음 표를 참조하십시오.

| 마이그레이션 유형 | 설명 | 사용 사례 | 스토리지 요구사항 |

|---|---|---|---|

| 실시간 마이그레이션 | KVM이 VM의 메모리 페이지를 대상 호스트로 전송하는 동안 VM은 소스 호스트 머신에서 계속 실행됩니다. 마이그레이션이 거의 완료되면 KVM은 VM을 매우 일시 중단하고 대상 호스트에서 다시 시작합니다. | 지속적인 가동 시간이 필요한 VM에 유용합니다. 그러나 I/O 로드가 많은 VM과 같이 KVM에서 메모리 페이지를 더 빠르게 수정하는 VM은 실시간 마이그레이션할 수 없으며 대신 비실시간 마이그레이션 을 사용해야 합니다. | VM의 디스크 이미지는 마이그레이션 중에 소스 호스트와 대상 호스트에 모두 액세스할 수 있어야 합니다. (1) |

| 실시간이 아닌 마이그레이션 | VM을 일시 중단하고 해당 구성 및 해당 메모리를 대상 호스트에 복사한 다음 VM을 다시 시작합니다. | VM의 다운타임을 생성하지만 실시간 마이그레이션보다 일반적으로 더 안정적입니다. 메모리 로드가 많은 VM에 권장됩니다. | VM의 디스크 이미지는 마이그레이션 중에 소스 호스트와 대상 호스트에 모두 액세스할 수 있어야 합니다. (1) |

| 하이브리드 마이그레이션 | 실시간 마이그레이션 및 실시간 이 아닌 마이그레이션 의 결합 . 실시간 마이그레이션 중에 소스 VM을 일시 중단하여 추가 더티 메모리 페이지가 생성되지 않습니다. 결과적으로 마이그레이션이 완료될 가능성이 훨씬 높아집니다. | 예를 들어 매우 많은 vCPU 또는 많은 양의 메모리를 사용하는 VM을 실시간 마이그레이션하여 마이그레이션이 완료되지 않도록 하는 것이 좋습니다. 게스트 워크로드 및 마이그레이션 중 정적 페이지 수에 따라 하이브리드 마이그레이션으로 인해 실시간이 아닌 마이그레이션보다 다운 타임이 크게 줄어들 수 있습니다. | VM의 디스크 이미지는 마이그레이션 중에 소스 호스트와 대상 호스트에 모두 액세스할 수 있어야 합니다. (1) |

| 오프라인 마이그레이션 | VM의 구성을 대상 호스트로 이동 | VM을 종료하는 경우 VM을 종료하고 VM을 종료해도 워크로드가 중단되지 않습니다. | VM의 디스크 이미지는 공유 네트워크에서 사용할 수 없으며 대상 호스트에서 수동으로 복사하거나 이동할 수 있습니다. |

(1) 이 작업을 수행하려면 다음 중 하나를 사용합니다.

- 공유 네트워크에 있는스토리지

-

virsh migrate명령의--copy-storage-all매개 변수는 네트워크를 통해 소스에서 대상으로 디스크 이미지 콘텐츠를 복사합니다. - SAN(Storage Area Network) 논리 단위(LUN).

- Ceph 스토리지 클러스터

12.2. 가상 머신 마이그레이션의 이점

VM(가상 머신) 마이그레이션은 다음을 위해 유용할 수 있습니다.

- 로드 밸런싱

- 호스트가 과부하되거나 다른 호스트가 활용도가 낮은 경우 VM을 더 낮은 사용량이 있는 호스트 시스템으로 이동할 수 있습니다.

- 하드웨어 독립

- 호스트 시스템에서 하드웨어 장치를 업그레이드, 추가 또는 제거해야 하는 경우 VM을 다른 호스트로 안전하게 재배치할 수 있습니다. 즉, 하드웨어 개선을 위해 VM에 다운타임이 발생하지 않습니다.

- 에너지 저장

- VM을 다른 호스트에 재배포할 수 있으므로 언로드된 호스트 시스템의 전원을 꺼서 낮은 사용 기간 동안 비용을 절감할 수 있습니다.

- 지역 마이그레이션

- 대기 시간이 단축되거나 다른 이유로 필요한 경우 VM을 다른 물리적 위치로 이동할 수 있습니다.

12.3. 가상 머신 마이그레이션 제한

RHEL 9에서 VM(가상 머신)을 마이그레이션하기 전에 마이그레이션의 제한 사항을 알고 있어야 합니다.

-

libvirt에서 또는 세션 연결에서 VM을 마이그레이션하는 것은 안정적이지 않으므로 권장되지 않습니다. 마이그레이션 시 특정 기능 및 구성을 사용하는 VM이 제대로 작동하지 않거나 마이그레이션이 실패합니다. 이러한 기능은 다음과 같습니다.

- 장치 패스스루

- SR-IOV 장치 할당

- 미디어된 장치(예: vGPUs)

- NUMA(Non-Uniform Memory Access) 고정을 사용하는 호스트 간 마이그레이션은 호스트에 유사한 토폴로지가 있는 경우에만 작동합니다. 그러나 실행 중인 워크로드의 성능은 마이그레이션에 부정적인 영향을 미칠 수 있습니다.

에뮬레이션된 CPU(소스 VM과 대상 VM 둘 다)는 동일해야 합니다. 그렇지 않으면 마이그레이션이 실패할 수 있습니다. 다음 CPU 관련 영역에서 VM 간의 차이로 인해 마이그레이션에 문제가 발생할 수 있습니다.

CPU 모델

- Intel 64 호스트와 AMD64 호스트 간에 마이그레이션하는 것은 x86-64 명령 세트를 공유하더라도 지원되지 않습니다.

- 다른 CPU 모델을 사용하여 호스트로 마이그레이션한 후 VM이 제대로 작동하는지 확인하는 단계는 가상 머신 마이그레이션에 대한 호스트 CPU 호환성 확인을 참조하십시오.

- 펌웨어 설정

- 마이크로 코드 버전

- BIOS 버전

- BIOS 설정

- QEMU 버전

- 커널 버전

- 경우에 따라 1TB 이상의 메모리를 사용하는 VM을 실시간으로 마이그레이션할 수 있습니다. 이 문제를 방지하거나 해결하는 방법에 대한 자세한 내용은 VM 실시간 마이그레이션에 완료하지 않고 오랜 시간이 걸립니다.

12.4. 가상 머신 마이그레이션을 위한 호스트 CPU 호환성 확인

마이그레이션된 VM(가상 머신)이 대상 호스트에서 올바르게 작동하려면 소스 및 대상 호스트의 CPU가 호환되어야 합니다. 이 경우 마이그레이션을 시작하기 전에 공통 CPU 기준선을 계산합니다.

이 섹션의 지침은 다음 호스트 CPU와 함께 마이그레이션 시나리오 예제를 사용합니다.

- 소스 호스트: Intel Core i7-8650U

- 대상 호스트: Intel Xeon CPU E5-2620 v2

사전 요구 사항

- 가상화가 시스템에 설치 및 활성화되어 있습니다.

- 소스 호스트에 대한 관리자 액세스 권한과 마이그레이션의 대상 호스트가 있습니다.

프로세스

소스 호스트에서 CPU 기능을 가져와서

domCaps-CPUs.xml과 같은 새 XML 파일에 붙여넣습니다.# virsh domcapabilities | xmllint --xpath "//cpu/mode[@name='host-model']" - > domCaps-CPUs.xml-

XML 파일에서 <mode> <

/mode> 태그를 <cpu> </cpu>로 바꿉니다. 선택 사항:

domCaps-CPUs.xml파일의 콘텐츠가 다음과 유사한지 확인합니다.# cat domCaps-CPUs.xml <cpu> <model fallback="forbid">Skylake-Client-IBRS</model> <vendor>Intel</vendor> <feature policy="require" name="ss"/> <feature policy="require" name="vmx"/> <feature policy="require" name="pdcm"/> <feature policy="require" name="hypervisor"/> <feature policy="require" name="tsc_adjust"/> <feature policy="require" name="clflushopt"/> <feature policy="require" name="umip"/> <feature policy="require" name="md-clear"/> <feature policy="require" name="stibp"/> <feature policy="require" name="arch-capabilities"/> <feature policy="require" name="ssbd"/> <feature policy="require" name="xsaves"/> <feature policy="require" name="pdpe1gb"/> <feature policy="require" name="invtsc"/> <feature policy="require" name="ibpb"/> <feature policy="require" name="ibrs"/> <feature policy="require" name="amd-stibp"/> <feature policy="require" name="amd-ssbd"/> <feature policy="require" name="rsba"/> <feature policy="require" name="skip-l1dfl-vmentry"/> <feature policy="require" name="pschange-mc-no"/> <feature policy="disable" name="hle"/> <feature policy="disable" name="rtm"/> </cpu>대상 호스트에서 다음 명령을 사용하여 CPU 기능을 가져옵니다.

# virsh domcapabilities | xmllint --xpath "//cpu/mode[@name='host-model']" - <mode name="host-model" supported="yes"> <model fallback="forbid">IvyBridge-IBRS</model> <vendor>Intel</vendor> <feature policy="require" name="ss"/> <feature policy="require" name="vmx"/> <feature policy="require" name="pdcm"/> <feature policy="require" name="pcid"/> <feature policy="require" name="hypervisor"/> <feature policy="require" name="arat"/> <feature policy="require" name="tsc_adjust"/> <feature policy="require" name="umip"/> <feature policy="require" name="md-clear"/> <feature policy="require" name="stibp"/> <feature policy="require" name="arch-capabilities"/> <feature policy="require" name="ssbd"/> <feature policy="require" name="xsaveopt"/> <feature policy="require" name="pdpe1gb"/> <feature policy="require" name="invtsc"/> <feature policy="require" name="ibpb"/> <feature policy="require" name="amd-ssbd"/> <feature policy="require" name="skip-l1dfl-vmentry"/> <feature policy="require" name="pschange-mc-no"/> </mode>-

대상 호스트에서 가져온 CPU 기능을 소스 호스트의

domCaps-CPUs.xml파일에 추가합니다. 다시 <mode> </mode> 태그를 <cpu> </cpu>로 바꾸고 파일을 저장합니다. 선택 사항: XML 파일에 이제 두 호스트의 CPU 기능이 포함되어 있는지 확인합니다.

# cat domCaps-CPUs.xml <cpu> <model fallback="forbid">Skylake-Client-IBRS</model> <vendor>Intel</vendor> <feature policy="require" name="ss"/> <feature policy="require" name="vmx"/> <feature policy="require" name="pdcm"/> <feature policy="require" name="hypervisor"/> <feature policy="require" name="tsc_adjust"/> <feature policy="require" name="clflushopt"/> <feature policy="require" name="umip"/> <feature policy="require" name="md-clear"/> <feature policy="require" name="stibp"/> <feature policy="require" name="arch-capabilities"/> <feature policy="require" name="ssbd"/> <feature policy="require" name="xsaves"/> <feature policy="require" name="pdpe1gb"/> <feature policy="require" name="invtsc"/> <feature policy="require" name="ibpb"/> <feature policy="require" name="ibrs"/> <feature policy="require" name="amd-stibp"/> <feature policy="require" name="amd-ssbd"/> <feature policy="require" name="rsba"/> <feature policy="require" name="skip-l1dfl-vmentry"/> <feature policy="require" name="pschange-mc-no"/> <feature policy="disable" name="hle"/> <feature policy="disable" name="rtm"/> </cpu> <cpu> <model fallback="forbid">IvyBridge-IBRS</model> <vendor>Intel</vendor> <feature policy="require" name="ss"/> <feature policy="require" name="vmx"/> <feature policy="require" name="pdcm"/> <feature policy="require" name="pcid"/> <feature policy="require" name="hypervisor"/> <feature policy="require" name="arat"/> <feature policy="require" name="tsc_adjust"/> <feature policy="require" name="umip"/> <feature policy="require" name="md-clear"/> <feature policy="require" name="stibp"/> <feature policy="require" name="arch-capabilities"/> <feature policy="require" name="ssbd"/> <feature policy="require" name="xsaveopt"/> <feature policy="require" name="pdpe1gb"/> <feature policy="require" name="invtsc"/> <feature policy="require" name="ibpb"/> <feature policy="require" name="amd-ssbd"/> <feature policy="require" name="skip-l1dfl-vmentry"/> <feature policy="require" name="pschange-mc-no"/> </cpu>XML 파일을 사용하여 마이그레이션하려는 VM의 CPU 기능 기준선을 계산합니다.

# virsh hypervisor-cpu-baseline domCaps-CPUs.xml <cpu mode='custom' match='exact'> <model fallback='forbid'>IvyBridge-IBRS</model> <vendor>Intel</vendor> <feature policy='require' name='ss'/> <feature policy='require' name='vmx'/> <feature policy='require' name='pdcm'/> <feature policy='require' name='pcid'/> <feature policy='require' name='hypervisor'/> <feature policy='require' name='arat'/> <feature policy='require' name='tsc_adjust'/> <feature policy='require' name='umip'/> <feature policy='require' name='md-clear'/> <feature policy='require' name='stibp'/> <feature policy='require' name='arch-capabilities'/> <feature policy='require' name='ssbd'/> <feature policy='require' name='xsaveopt'/> <feature policy='require' name='pdpe1gb'/> <feature policy='require' name='invtsc'/> <feature policy='require' name='ibpb'/> <feature policy='require' name='amd-ssbd'/> <feature policy='require' name='skip-l1dfl-vmentry'/> <feature policy='require' name='pschange-mc-no'/> </cpu>마이그레이션하려는 VM의 XML 구성을 열고 <

cpu> 섹션의 내용을 이전 단계에서 가져온 설정으로 교체합니다.# virsh edit VM-nameVM이 실행 중인 경우 다시 시작합니다.

# virsh reboot VM-name

12.5. 다른 호스트와 가상 머신 디스크 이미지 공유

지원되는 KVM 호스트 간에 VM(가상 머신)을 실시간 마이그레이션하려면 VM이 마이그레이션 프로세스 중 스토리지에서 읽고 쓸 수 있는 방식으로 실행 중인 VM의 스토리지를 마이그레이션해야 합니다.

이를 수행하는 방법 중 하나는 공유 VM 스토리지를 사용하는 것입니다. 다음 절차에서는 NFS 프로토콜을 사용하여 로컬에 저장된 VM 이미지를 소스 호스트 및 대상 호스트와 공유하는 방법을 설명합니다.

사전 요구 사항

- 마이그레이션을 위한 VM이 종료됩니다.

- 선택 사항: 호스트 시스템은 소스 또는 대상 호스트가 아닌 스토리지를 호스팅하는 데 사용할 수 있지만 소스와 대상 호스트는 네트워크를 통해 연결할 수 있습니다. 이는 공유 스토리지에 최적의 솔루션이며 Red Hat에서 권장합니다.

- KVM에서 지원되지 않으므로 NFS 파일 잠금이 사용되지 않는지 확인합니다.

- NFS 프로토콜은 소스 및 대상 호스트에 설치되어 활성화되어 있습니다. 참조

- NFS 서버 배포.

프로세스

공유 스토리지를 제공할 호스트에 연결합니다. 이 예에서는

example-shared-storage호스트입니다.# ssh root@example-shared-storage root@example-shared-storage's password: Last login: Mon Sep 24 12:05:36 2019 root~#디스크 이미지를 보유하고 마이그레이션 호스트와 공유할 소스 호스트에 디렉터리를 생성합니다.

# mkdir /var/lib/libvirt/shared-images소스 호스트에서 새로 생성된 디렉터리로 VM의 디스크 이미지를 복사합니다. 다음 예제에서는 VM의 디스크 이미지

example-disk-1을example-shared-storage호스트의/var/lib/libvirt/shared-images/디렉터리에 복사합니다.# scp /var/lib/libvirt/images/example-disk-1.qcow2 root@example-shared-storage:/var/lib/libvirt/shared-images/example-disk-1.qcow2스토리지를 공유하는 데 사용할 호스트에서 공유 디렉터리를

/etc/exports파일에 추가합니다. 다음 예제에서는/var/lib/libvirt/shared-images디렉터리를example-source-machine및example-destination-machine호스트와 공유합니다.# /var/lib/libvirt/shared-images example-source-machine(rw,no_root_squash) example-destination-machine(rw,no\_root_squash)소스 및 대상 호스트 모두에서 공유 디렉터리를

/var/lib/libvirt/images디렉터리에 마운트합니다.# mount example-shared-storage:/var/lib/libvirt/shared-images /var/lib/libvirt/images

검증

- 소스 호스트에서 VM을 시작하고 성공적으로 부팅되는지 확인합니다.

12.6. 명령줄 인터페이스를 사용하여 가상 머신 마이그레이션

VM(가상 머신)의 현재 호스트가 적합하지 않거나 더 이상 사용할 수 없거나 호스팅 워크로드를 재배포하려는 경우 VM을 다른 KVM 호스트로 마이그레이션할 수 있습니다. 다음 절차에서는 이러한 마이그레이션의 다양한 시나리오에 대한 지침 및 예를 제공합니다.

사전 요구 사항

- 소스 호스트와 대상 호스트는 모두 KVM 하이퍼바이저를 사용합니다.

-

소스 호스트와 대상 호스트는 네트워크를 통해 서로 연결할 수 있습니다.

ping유틸리티를 사용하여 이를 확인합니다. 대상 호스트에서 다음 포트가 열려 있는지 확인합니다.

- SSH를 사용하여 대상 호스트에 연결하려면 포트 22가 필요합니다.

- TLS를 사용하여 대상 호스트에 연결하려면 포트 16509가 필요합니다.

- TCP를 사용하여 대상 호스트에 연결하려면 포트 16514가 필요합니다.

- 메모리 및 디스크 마이그레이션 데이터를 전송하기 위해 QEMU에 포트 49152-49215가 필요합니다.

- Red Hat에서 마이그레이션을 지원하려면 소스 호스트와 대상 호스트에서 특정 운영 체제 및 시스템 유형을 사용해야 합니다. 이 경우 가상 머신 마이그레이션에 대한 지원되는 호스트를 참조하십시오.

- VM은 대상 호스트의 CPU 기능과 호환되어야 합니다. 이 경우 가상 머신 마이그레이션에 대한 호스트 CPU 호환성 확인을 참조하십시오.

마이그레이션할 VM의 디스크 이미지는 소스 호스트와 대상 호스트 둘 다에 액세스할 수 있습니다. 오프라인 마이그레이션에는 선택 사항이지만 실행 중인 VM을 마이그레이션하는 데 필요합니다. 두 호스트의 스토리지 접근성을 보장하려면 다음 중 하나를 적용해야 합니다.

- SAN(Storage Area Network) 논리 단위(LUN)를 사용하고 있습니다.

- Ceph 스토리지 클러스터를 사용하고 있습니다.

-

VM의 디스크 이미지를 대상 호스트에 복사했으며 VM을 마이그레이션할 때

--copy-storage-all매개변수를 사용합니다. 또는 소스 VM 디스크와 동일한 형식 및 크기로 디스크 이미지를 생성 했습니다. - 디스크 이미지는 별도의 네트워크 위치에 있습니다. 이러한 공유 VM 스토리지를 설정하는 방법은 다른 호스트와 가상 머신 디스크 이미지 공유를 참조하십시오.

실행 중인 VM을 마이그레이션할 때 네트워크 대역폭은 VM이 더티 메모리 페이지를 생성하는 속도보다 커야 합니다.

실시간 마이그레이션을 시작하기 전에 VM의 더티 페이지 속도를 얻으려면 다음을 수행하십시오.

짧은 기간 동안 VM의 더티 페이지 생성 속도를 모니터링합니다.

# virsh domdirtyrate-calc example-VM 30모니터링이 완료되면 결과를 가져옵니다.

# virsh domstats example-VM --dirtyrate Domain: 'example-VM' dirtyrate.calc_status=2 dirtyrate.calc_start_time=200942 dirtyrate.calc_period=30 dirtyrate.megabytes_per_second=2이 예제에서 VM은 초당 2MB의 더티 메모리 페이지를 생성합니다. 대역폭이 2MB/s 이하인 네트워크에서 이러한 VM을 실시간 마이그레이션하려고 하면 VM을 일시 중지하거나 워크로드를 낮추지 않으면 실시간 마이그레이션이 진행되지 않습니다.

실시간 마이그레이션이 성공적으로 완료되도록 Red Hat은 네트워크 대역폭이 VM의 더티 페이지 생성 속도보다 훨씬 큰 것을 권장합니다.

참고calc_period옵션의 값은 워크로드 및 더티 페이지 비율에 따라 다를 수 있습니다. 여러calc_period값을 실험하여 환경의 더티 페이지 비율과 정렬하는 가장 적합한 기간을 결정할 수 있습니다.

- 공용 브리지에서 기존 VM을 마이그레이션하는 경우 소스 및 대상 호스트가 동일한 네트워크에 있어야 합니다. 그렇지 않으면 마이그레이션 후 VM 네트워크가 작동하지 않습니다.

VM 마이그레이션을 수행할 때 소스 호스트의

virsh클라이언트는 여러 프로토콜 중 하나를 사용하여 대상 호스트의 libvirt 데몬에 연결할 수 있습니다. 다음 절차의 예제에서는 SSH 연결을 사용하지만 다른 연결을 선택할 수 있습니다.libvirt에서 SSH 연결을 사용하려면

virtqemud소켓이 활성화되어 대상 호스트에서 실행 중인지 확인합니다.# systemctl enable --now virtqemud.socketlibvirt에서 TLS 연결을 사용하려면

virtproxyd-tls소켓이 활성화되어 대상 호스트에서 실행 중인지 확인합니다.# systemctl enable --now virtproxyd-tls.socketlibvirt에서 TCP 연결을 사용하려면

virtproxyd-tcp소켓이 활성화되어 대상 호스트에서 실행 중인지 확인합니다.# systemctl enable --now virtproxyd-tcp.socket

프로세스

마이그레이션 요구 사항에 적합한 옵션과 함께

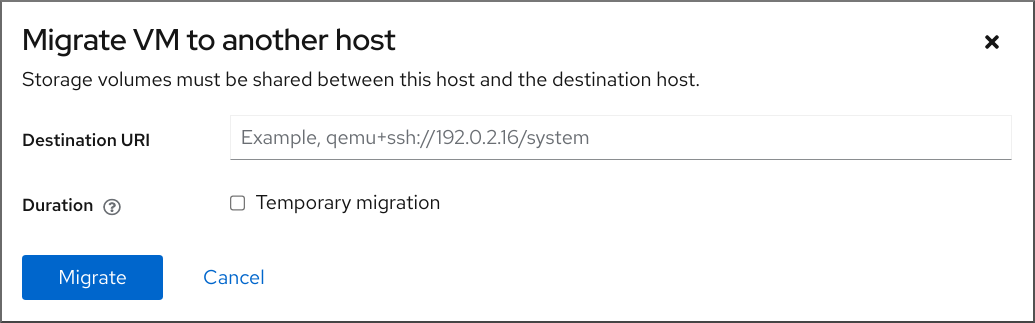

virsh migrate명령을 사용하십시오.다음 명령은 SSH 터널을 사용하여

example-VM-1VM을 로컬 호스트에서example-destination호스트의 시스템 연결로 마이그레이션합니다. VM은 마이그레이션 중에 계속 실행됩니다.# virsh migrate --persistent --live example-VM-1 qemu+ssh://example-destination/system다음 명령을 사용하면 로컬 호스트에서 실행 중인

example-VM-2VM의 구성을 수동으로 조정한 다음 VM을example-destination호스트로 마이그레이션할 수 있습니다. 마이그레이션된 VM은 업데이트된 구성을 자동으로 사용합니다.# virsh dumpxml --migratable example-VM-2 > example-VM-2.xml # vi example-VM-2.xml # virsh migrate --live --persistent --xml example-VM-2.xml example-VM-2 qemu+ssh://example-destination/system이 절차는 예를 들어 대상 호스트에서 공유 VM 스토리지에 액세스하거나 대상 호스트와 관련된 기능을 구성할 때 다른 경로를 사용해야 하는 경우에 유용할 수 있습니다.

다음 명령은

example-source호스트에서example-VM-3VM을 일시 중단하고,example-destination호스트로 마이그레이션한 다음example-VM-3-alt.xml파일에서 제공하는 조정된 XML 구성을 사용하도록 지시합니다. 마이그레이션이 완료되면libvirt가 대상 호스트에서 VM을 다시 시작합니다.# virsh migrate example-VM-3 qemu+ssh://example-source/system qemu+ssh://example-destination/system --xml example-VM-3-alt.xml마이그레이션 후 VM은 소스 호스트의 shut off 상태에 있으며 마이그레이션된 사본은 종료된 후 삭제됩니다.

다음은

example-source호스트에서 종료example-VM-4VM을 삭제하고 해당 구성을example-destination호스트로 이동합니다.# virsh migrate --offline --persistent --undefinesource example-VM-4 qemu+ssh://example-source/system qemu+ssh://example-destination/system이러한 유형의 마이그레이션에서는 VM의 디스크 이미지를 공유 스토리지로 이동할 필요가 없습니다. 그러나 대상 호스트에서 VM을 사용할 수 있으려면 VM의 디스크 이미지도 마이그레이션해야 합니다. 예를 들면 다음과 같습니다.

# scp root@example-source:/var/lib/libvirt/images/example-VM-4.qcow2 root@example-destination:/var/lib/libvirt/images/example-VM-4.qcow2다음 명령은 example-VM-5 VM을 example-destination 호스트로 마이그레이션하고 다중 파일 설명자(multi-FD) 마이그레이션이라고도 하는 여러 병렬 연결을 사용합니다. 멀티 FD 마이그레이션을 사용하면 마이그레이션 프로세스에 사용 가능한 모든 네트워크 대역폭을 활용하여 마이그레이션 속도를 높일 수 있습니다.

# virsh migrate --parallel --parallel-connections 4 <example-VM-5> qemu+ssh://<example-destination>/system이 예에서는 4개의 다중 FD 채널을 사용하여 example-VM-5 VM을 마이그레이션합니다. 사용 가능한 네트워크 대역폭의 10Gbps마다 하나의 채널을 사용하는 것이 좋습니다. 기본값은 2 채널입니다.

마이그레이션이 완료될 때까지 기다립니다. 이 프로세스는 네트워크 대역폭, 시스템 로드 및 VM 크기에 따라 다소 시간이 걸릴 수 있습니다.