安装后配置

OpenShift Container Platform 的第二天操作

摘要

第 1 章 安装后配置概述

安装 OpenShift Container Platform 后,集群管理员可以配置和自定义以下组件:

- 机器

- 集群

- 节点

- Network

- 存储

- 用户

- 警报和通知

1.1. 安装后要执行的配置任务

集群管理员可执行以下安装后配置任务:

配置操作系统功能 :Machine Config Operator(MCO)管理

MachineConfig对象。通过使用 MCO,您可以在 OpenShift Container Platform 集群中执行以下任务:-

使用

MachineConfig对象配置节点 - 配置 MCO 相关的自定义资源

-

使用

配置集群功能:作为集群管理员,您可以修改 OpenShift Container Platform 集群的主要功能的配置资源。这些功能包括:

- 镜像 registry

- 网络配置

- 镜像构建行为

- 用户身份提供程序

- etcd 配置

- 用于处理工作负载的机器集

- 云供应商凭证管理

将集群组件配置为私有 :默认情况下,安装程序使用公开的 DNS 和端点置备 OpenShift Container Platform。如果您希望集群只能从内部网络内部访问,请将以下组件配置为私有:

- DNS

- Ingress Controller

- API Server

执行节点操作 :默认情况下,OpenShift Container Platform 使用 Red Hat Enterprise Linux CoreOS(RHCOS)计算机器。作为集群管理员,您可以使用 OpenShift Container Platform 集群中的机器执行以下操作:

- 添加和删除计算机器

- 为节点添加和删除污点和容限

- 配置每个节点的最大 pod 数量

- 启用设备管理器

配置网络 :安装 OpenShift Container Platform 后,您可以配置以下内容:

- 入口集群流量

- 节点端口服务范围

- 网络策略

- 启用集群范围代理

配置存储 :默认情况下,容器使用临时存储或临时存储进行操作。临时存储具有生命周期限制。TO 长期存储数据,您必须配置持久性存储。您可以使用以下方法之一配置存储:

- 动态置备 :您可以通过定义并创建控制不同级别的存储类(包括存储访问)来按需动态置备存储。

- 静态置备 :您可以使用 Kubernetes 持久性卷使现有存储可供集群使用。静态置备支持各种设备配置和挂载选项。

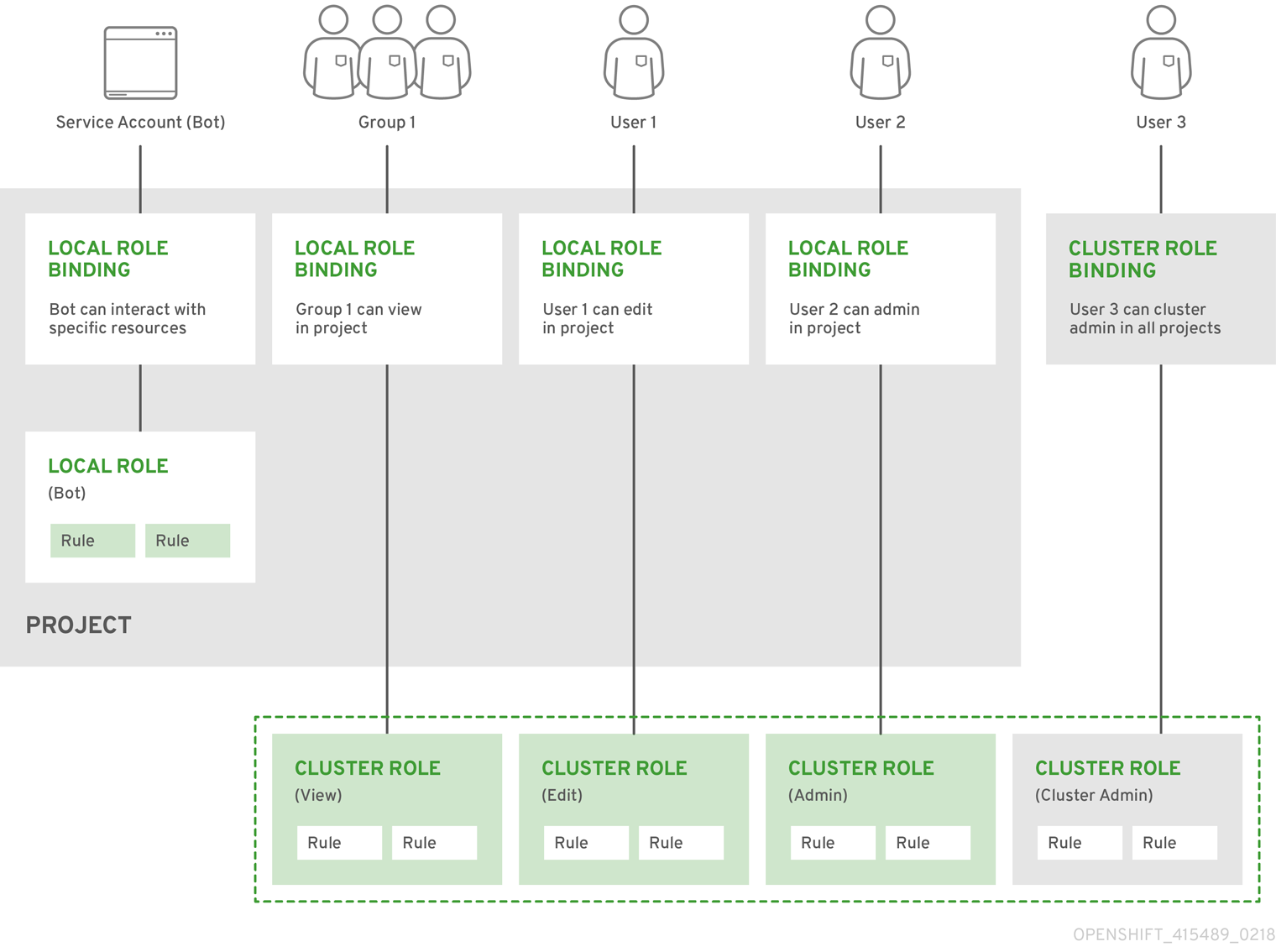

- 配置用户 :OAuth 访问令牌允许用户自行验证 API。作为集群管理员,您可以配置 OAuth 以执行以下任务:

- 指定身份提供程序

- 使用基于角色的访问控制为用户定义和授予权限

- 从 OperatorHub 安装 Operator

- 管理警报和通知 :默认情况下,触发的警报显示在 Web 控制台的 Alerting UI 中。您还可以配置 OpenShift Container Platform,将警报通知发送到外部系统。

第 2 章 配置私有集群

安装 OpenShift Container Platform 版本 4.8 集群后,您可以将其某些核心组件设置为私有。

2.1. 关于私有集群

默认情况下,OpenShift Container Platform 被置备为使用可公开访问的 DNS 和端点。在部署私有集群后,您可以将 DNS、Ingress Controller 和 API 服务器设置为私有。

如果集群有任何公共子网,管理员创建的负载均衡器服务可能会公开访问。为确保集群安全性,请验证这些服务是否已明确标注为私有。

DNS

如果在安装程序置备的基础架构上安装 OpenShift Container Platform,安装程序会在预先存在的公共区中创建记录,并在可能的情况下为集群自己的 DNS 解析创建一个私有区。在公共区和私有区中,安装程序或集群为 *.apps 和 Ingress 对象创建 DNS 条目,并为 API 服务器创建 api。

公共和私有区中的 *.apps 记录是相同的,因此当您删除公有区时,私有区为集群无缝地提供所有 DNS 解析。

Ingress Controller

由于默认 Ingress 对象是作为公共对象创建的,所以负载均衡器是面向互联网的,因此在公共子网中。您可以将默认 Ingress Controller 替换为内部控制器。

API Server

默认情况下,安装程序为 API 服务器创建适当的网络负载均衡器,供内部和外部流量使用。

在 Amazon Web Services(AWS)上,会分别创建独立的公共和私有负载均衡器。负载均衡器是基本相同的,唯一不同是带有一个额外的、用于在集群内部使用的端口。虽然安装程序根据 API 服务器要求自动创建或销毁负载均衡器,但集群并不管理或维护它们。只要保留集群对 API 服务器的访问,您可以手动修改或移动负载均衡器。对于公共负载均衡器,需要打开端口 6443,并根据 /readyz 路径配置 HTTPS 用于健康检查。

在 Google Cloud Platform 上,会创建一个负载均衡器来管理内部和外部 API 流量,因此您无需修改负载均衡器。

在 Microsoft Azure 上,会创建公共和私有负载均衡器。但是,由于当前实施的限制,您刚刚在私有集群中保留两个负载均衡器。

2.2. 将 DNS 设置为私有

部署集群后,您可以修改其 DNS 使其只使用私有区。

流程

查看集群的

DNS自定义资源:$ oc get dnses.config.openshift.io/cluster -o yaml输出示例

apiVersion: config.openshift.io/v1 kind: DNS metadata: creationTimestamp: "2019-10-25T18:27:09Z" generation: 2 name: cluster resourceVersion: "37966" selfLink: /apis/config.openshift.io/v1/dnses/cluster uid: 0e714746-f755-11f9-9cb1-02ff55d8f976 spec: baseDomain: <base_domain> privateZone: tags: Name: <infrastructure_id>-int kubernetes.io/cluster/<infrastructure_id>: owned publicZone: id: Z2XXXXXXXXXXA4 status: {}请注意,

spec部分包含一个私有区和一个公共区。修补

DNS自定义资源以删除公共区:$ oc patch dnses.config.openshift.io/cluster --type=merge --patch='{"spec": {"publicZone": null}}' dns.config.openshift.io/cluster patched因为 Ingress Controller 在创建

Ingress对象时会参考DNS定义,因此当您创建或修改Ingress对象时,只会创建私有记录。重要在删除公共区时,现有 Ingress 对象的 DNS 记录不会修改。

可选:查看集群的

DNS自定义资源,并确认已删除公共区:$ oc get dnses.config.openshift.io/cluster -o yaml输出示例

apiVersion: config.openshift.io/v1 kind: DNS metadata: creationTimestamp: "2019-10-25T18:27:09Z" generation: 2 name: cluster resourceVersion: "37966" selfLink: /apis/config.openshift.io/v1/dnses/cluster uid: 0e714746-f755-11f9-9cb1-02ff55d8f976 spec: baseDomain: <base_domain> privateZone: tags: Name: <infrastructure_id>-int kubernetes.io/cluster/<infrastructure_id>-wfpg4: owned status: {}

2.3. 将 Ingress Controller 设置为私有

部署集群后,您可以修改其 Ingress Controller 使其只使用私有区。

流程

修改默认 Ingress Controller,使其仅使用内部端点:

$ oc replace --force --wait --filename - <<EOF apiVersion: operator.openshift.io/v1 kind: IngressController metadata: namespace: openshift-ingress-operator name: default spec: endpointPublishingStrategy: type: LoadBalancerService loadBalancer: scope: Internal EOF输出示例

ingresscontroller.operator.openshift.io "default" deleted ingresscontroller.operator.openshift.io/default replaced删除公共 DNS 条目,并更新私有区条目。

2.4. 将 API 服务器限制为私有

将集群部署到 Amazon Web Services(AWS)或 Microsoft Azure 后,可以重新配置 API 服务器,使其只使用私有区。

先决条件

-

安装 OpenShift CLI(

oc)。 -

使用具有

admin权限的用户登陆到 web 控制台。

流程

在 AWS 或 Azure 的 web 门户或控制台中,执行以下操作:

找到并删除相关的负载均衡器组件。

- 对于 AWS,删除外部负载均衡器。私有区的 API DNS 条目已指向内部负载均衡器,它使用相同的配置,因此您无需修改内部负载均衡器。

-

对于 Azure,删除负载均衡器的

api-internal规则。

-

在公共区中删除

api.$clustername.$yourdomainDNS 条目。

删除外部负载均衡器:

重要您只能对安装程序置备的基础架构 (IPI) 集群执行以下步骤。对于用户置备的基础架构 (UPI) 集群,您必须手动删除或禁用外部负载均衡器。

在终端中列出集群机器:

$ oc get machine -n openshift-machine-api输出示例

NAME STATE TYPE REGION ZONE AGE lk4pj-master-0 running m4.xlarge us-east-1 us-east-1a 17m lk4pj-master-1 running m4.xlarge us-east-1 us-east-1b 17m lk4pj-master-2 running m4.xlarge us-east-1 us-east-1a 17m lk4pj-worker-us-east-1a-5fzfj running m4.xlarge us-east-1 us-east-1a 15m lk4pj-worker-us-east-1a-vbghs running m4.xlarge us-east-1 us-east-1a 15m lk4pj-worker-us-east-1b-zgpzg running m4.xlarge us-east-1 us-east-1b 15m在以下步骤中,修改 control plane 机器(名称中包含

master的机器)。从每台 control plane 机器移除外部负载均衡器。

编辑 control plane

Machine对象以移除对外部负载均衡器的引用:$ oc edit machines -n openshift-machine-api <master_name>1 - 1

- 指定要修改的 control plane 或 master

Machine对象的名称。

删除描述外部负载均衡器的行(在以下示例中已被标记),保存并退出对象规格:

... spec: providerSpec: value: ... loadBalancers: - name: lk4pj-ext1 type: network2 - name: lk4pj-int type: network-

对名称中包含

master的每个机器重复这个过程。

第 3 章 安装后机器配置任务

有时您需要更改 OpenShift Container Platform 节点上运行的操作系统。这包括更改网络时间服务的设置、添加内核参数或者以特定的方式配置日志。

除了一些特殊功能外,通过创建称为 Machine Config Operator 管理的 MachineConfig 对象,可以对 OpenShift Container Platform 节点上的操作系统进行大多数更改。

本节中的任务介绍了如何使用 Machine Config Operator 的功能在 OpenShift Container Platform 节点上配置操作系统功能。

3.1. 了解 Machine Config Operator

3.1.1. Machine Config Operator

用途

Machine Congig Operator 管理并应用基本操作系统和容器运行时的配置和更新,包括内核和 kubelet 之间的所有配置和更新。

有四个组件:

-

machine-config-server:为加入集群的新机器提供 Ignition 配置。 -

machine-config-controller:协调机器升级到MachineConfig对象定义的配置。提供用来控制单独一组机器升级的选项。 -

machine-config-daemon:在更新过程中应用新机器配置。验证并验证机器的状态到请求的机器配置。 -

machine-config:提供安装、首次启动和更新一个机器的完整机器配置源。

project

3.1.2. 机器配置概述

Machine Config Operator(MCO)管理对 systemd、CRI-O 和 Kubelet、内核、Network Manager 和其他系统功能的更新。它还提供了一个 MachineConfig CRD,它可以在主机上写入配置文件(请参阅 machine-config-operator)。了解 MCO 的作用以及如何与其他组件交互对于对 OpenShift Container Platform 集群进行高级系统级更改至关重要。以下是您应该了解的 MCO、机器配置以及它们的使用方式:

- 机器配置可以对每个系统的操作系统上的文件或服务进行特定的更改,代表一个 OpenShift Container Platform 节点池。

MCO 应用对机器池中的操作系统的更改。所有 OpenShift Container Platform 集群都以 worker 和 control plane 节点(也称为 master 节点)池开头。通过添加更多角色标签,您可以配置自定义节点池。例如,您可以设置一个自定义的 worker 节点池,其中包含应用程序所需的特定硬件功能。但是,本节中的示例着重介绍了对默认池类型的更改。

重要一个节点可以应用多个标签来指示其类型,如

master或worker,但只能是一个单一机器配置池的成员。- 在将 OpenShift Container Platform 安装到磁盘前,必须先进行一些机器配置。在大多数情况下,这可以通过创建直接注入 OpenShift Container Platform 安装程序进程中的机器配置来实现,而不必作为安装后机器配置运行。在其他情况下,您可能需要在 OpenShift Container Platform 安装程序启动时传递内核参数时进行裸机安装,以完成诸如设置每个节点的 IP 地址或高级磁盘分区等操作。

- MCO 管理机器配置中设置的项目。MCO 不会覆盖您对系统进行的手动更改,除非明确告知 MCO 管理冲突文件。换句话说,MCO 只提供您请求的特定更新,它不会声明对整个节点的控制。

- 强烈建议手动更改节点。如果您需要退出某个节点并启动一个新节点,则那些直接更改将会丢失。

-

MCO 只支持写入

/etc和/var目录里的文件,虽然有些目录的符号链接可以通过符号链接到那些区域之一来写入。例如/opt和/usr/local目录。 - Ignition 是 MachineConfig 中使用的配置格式。详情请参阅 Ignition 配置规格 v3.2.0。

- 虽然 Ignition 配置设置可以在 OpenShift Container Platform 安装时直接交付,且以 MCO 提供 Ignition 配置的方式格式化,但 MCO 无法查看这些原始 Ignition 配置是什么。因此,您应该在部署 Ignition 配置前将 Ignition 配置设置嵌套到机器配置中。

-

当由 MCO 管理的文件在 MCO 之外更改时,Machine Config Daemon(MCD)会将该节点设置为

degraded。然而,它不会覆盖这个错误的文件,它应该继续处于degraded(降级)状态。 -

使用机器配置的一个关键原因是,当您为 OpenShift Container Platform 集群中的池添加新节点时,会应用它。

machine-api-operator置备一个新机器, MCO 配置它。

MCO 使用 Ignition 作为配置格式。OpenShift Container Platform 4.6 从 Ignition 配置规格版本 2 移到版本 3。

3.1.2.1. 机器配置可以更改什么?

MCO 可更改的组件类型包括:

config:创建 Ignition 配置对象(请参阅 Ignition 配置规格),以完成修改 OpenShift Container Platform 机器上的文件、systemd 服务和其他功能,包括:

-

Configuration files:创建或覆盖

/var或/etc目录中的文件。 - systemd units:在附加设置中丢弃并设置 systemd 服务的状态,或者添加到现有 systemd 服务中。

- 用户和组:在安装后更改 passwd 部分中的 SSH 密钥。

-

Configuration files:创建或覆盖

只有 core 用户才支持通过机器配置更改 SSH 密钥。

- kernelArguments:在 OpenShift Container Platform 节点引导时在内核命令行中添加参数。

-

kernelType:(可选)使用非标准内核而不是标准内核。使用

realtime来使用 RT 内核(用于 RAN)。这只在选择的平台上被支持。 - fips:启用 FIPS 模式。不应在安装时设置 FIPS,而不是安装后的步骤。

只有在 x86_64 架构中的 OpenShift Container Platform 部署支持 FIPS 验证的/Modules in Process 加密库。

- extensions:通过添加所选预打包软件来扩展 RHCOS 功能。对于这个功能,可用的扩展程序包括 usbguard 和内核模块。

-

Custom resources(用于

ContainerRuntime和Kubelet):在机器配置外,MCO 管理两个特殊自定义资源,用于修改 CRI-O 容器运行时设置(ContainerRuntimeCR)和 Kubelet 服务(KubeletCR)。

MCO 不是更改 OpenShift Container Platform 节点上的操作系统组件的唯一 Operator。其他 Operator 也可以修改操作系统级别的功能。一个例子是 Node Tuning Operator,它允许您通过 Tuned 守护进程配置集进行节点级别的性能优化。

安装后可以进行的 MCO 配置任务包括在以下步骤中。如需在 OpenShift Container Platform 安装过程中或之前完成的系统配置任务,请参阅 RHCOS 裸机安装的描述。

3.1.2.2. project

详情请参阅 openshift-machine-config-operator GitHub 站点。

3.1.3. 检查机器配置池状态

要查看 Machine Config Operator(MCO)、其子组件及其管理的资源的状态,请使用以下 oc 命令:

流程

要查看集群中为每个机器配置池 (MCP) 中可用 MCO 管理的节点数量,请运行以下命令:

$ oc get machineconfigpool输出示例

NAME CONFIG UPDATED UPDATING DEGRADED MACHINECOUNT READYMACHINECOUNT UPDATEDMACHINECOUNT DEGRADEDMACHINECOUNT AGE master rendered-master-06c9c4… True False False 3 3 3 0 4h42m worker rendered-worker-f4b64… False True False 3 2 2 0 4h42m其中:

- UPDATED

-

True状态表示 MCO 已将当前机器配置应用到该 MCP 中的节点。当前机器配置在oc get mcp输出中的STATUS字段中指定。False状态表示 MCP 中的节点正在更新。 - UPDATING

-

True状态表示 MCO 正在按照MachineConfigPool自定义资源中的规定应用到该 MCP 中的至少一个节点。所需的机器配置是新编辑的机器配置。要进行更新的节点可能不适用于调度。False状态表示 MCP 中的所有节点都已更新。 - DEGRADED

-

True状态表示 MCO 被禁止将当前或所需的机器配置应用到该 MCP 中的至少一个节点,或者配置失败。降级的节点可能不适用于调度。False状态表示 MCP 中的所有节点都就绪。 - MACHINECOUNT

- 表示该 MCP 中的机器总数。

- READYMACHINECOUNT

- 指明 MCP 中准备进行调度的机器总数。

- UPDATEDMACHINECOUNT

- 指明 MCP 中有当前机器配置的机器总数。

- DEGRADEDMACHINECOUNT

- 指明 MCP 中标记为 degraded 或 unreconcilable 的机器总数。

在前面的输出中,有三个 control plane (master) 节点和三个 worker 节点。control plane MCP 和关联的节点更新至当前机器配置。worker MCP 中的节点会更新为所需的机器配置。worker MCP 中的两个节点被更新,一个仍在更新,如

UPDATEDMACHINECOUNT为2。没有问题,如DEGRADEDMACHINECOUNT为0,DEGRADED为False。虽然 MCP 中的节点正在更新,但

CONFIG下列出的机器配置是当前的机器配置,该配置会从这个配置进行更新。更新完成后,列出的机器配置是所需的机器配置,它被更新为 MCP。注意如果节点被封锁,则该节点不包含在

READYMACHINECOUNT中,但包含在MACHINECOUNT中。另外,MCP 状态被设置为UPDATING。因为节点具有当前的机器配置,所以它被计算在UPDATEDMACHINECOUNT总计:输出示例

NAME CONFIG UPDATED UPDATING DEGRADED MACHINECOUNT READYMACHINECOUNT UPDATEDMACHINECOUNT DEGRADEDMACHINECOUNT AGE master rendered-master-06c9c4… True False False 3 3 3 0 4h42m worker rendered-worker-c1b41a… False True False 3 2 3 0 4h42m要通过检查

MachineConfigPool自定义资源来检查 MCP 中的节点状态,请运行以下命令:$ oc describe mcp worker输出示例

... Degraded Machine Count: 0 Machine Count: 3 Observed Generation: 2 Ready Machine Count: 3 Unavailable Machine Count: 0 Updated Machine Count: 3 Events: <none>注意如果节点被封锁,则节点不包含在

Ready Machine Count中。它包含在Unavailable Machine Count中:输出示例

... Degraded Machine Count: 0 Machine Count: 3 Observed Generation: 2 Ready Machine Count: 2 Unavailable Machine Count: 1 Updated Machine Count: 3要查看每个现有的

MachineConfig对象,请运行以下命令:$ oc get machineconfigs输出示例

NAME GENERATEDBYCONTROLLER IGNITIONVERSION AGE 00-master 2c9371fbb673b97a6fe8b1c52... 3.2.0 5h18m 00-worker 2c9371fbb673b97a6fe8b1c52... 3.2.0 5h18m 01-master-container-runtime 2c9371fbb673b97a6fe8b1c52... 3.2.0 5h18m 01-master-kubelet 2c9371fbb673b97a6fe8b1c52… 3.2.0 5h18m ... rendered-master-dde... 2c9371fbb673b97a6fe8b1c52... 3.2.0 5h18m rendered-worker-fde... 2c9371fbb673b97a6fe8b1c52... 3.2.0 5h18m请注意,列为

rendered的MachineConfig对象并不意味着要更改或删除。要查看特定机器配置的内容(本例中为

01-master-kubelet),请运行以下命令:$ oc describe machineconfigs 01-master-kubelet命令的输出显示此

MachineConfig对象同时包含配置文件(cloud.conf和kubelet.conf) 和 systemd 服务(Kubernetes Kubelet):输出示例

Name: 01-master-kubelet ... Spec: Config: Ignition: Version: 3.2.0 Storage: Files: Contents: Source: data:, Mode: 420 Overwrite: true Path: /etc/kubernetes/cloud.conf Contents: Source: data:,kind%3A%20KubeletConfiguration%0AapiVersion%3A%20kubelet.config.k8s.io%2Fv1beta1%0Aauthentication%3A%0A%20%20x509%3A%0A%20%20%20%20clientCAFile%3A%20%2Fetc%2Fkubernetes%2Fkubelet-ca.crt%0A%20%20anonymous... Mode: 420 Overwrite: true Path: /etc/kubernetes/kubelet.conf Systemd: Units: Contents: [Unit] Description=Kubernetes Kubelet Wants=rpc-statd.service network-online.target crio.service After=network-online.target crio.service ExecStart=/usr/bin/hyperkube \ kubelet \ --config=/etc/kubernetes/kubelet.conf \ ...

如果应用的机器配置出现问题,您可以随时退出这一更改。例如,如果您运行 oc create -f ./myconfig.yaml 以应用机器配置,您可以运行以下命令来删除该机器配置:

$ oc delete -f ./myconfig.yaml如果这是唯一的问题,则受影响池中的节点应返回非降级状态。这会导致呈现的配置回滚到其之前更改的状态。

如果在集群中添加自己的机器配置,您可以使用上例中显示的命令检查其状态以及应用到它们的池的相关状态。

3.2. 使用 MachineConfig 对象配置节点

您可以使用本节中的任务创建 MachineConfig 对象,修改 OpenShift Container Platform 节点上运行的文件、systemd 单元文件和其他操作系统功能。有关使用机器配置的更多信息,请参阅有关 更新 SSH 授权密钥、验证镜像签名、启用 SCTP 的内容,并为 OpenShift Container Platform 配置 iSCSI initiatorname。

OpenShift Container Platform 支持 Ignition 规格版本 3.2。您创建的所有新机器配置都应该基于 Ignition 规格版本 3.2。如果要升级 OpenShift Container Platform 集群,任何现有的 Ignition 规格版本 2.x 机器配置将自动转换为规格版本 3.2。

使用 "Configuring chrony time service" 部分作为如何将其他配置文件添加到 OpenShift Container Platform 节点的模型。

3.2.1. 配置 chrony 时间服务

您可以通过修改 chrony .conf 文件的内容,并将这些内容作为机器配置传递给节点,从而设置 chrony 时间服务(chronyd)使用的时间服务器和相关设置。

流程

创建一个 Butane 配置,包括

chrony.conf文件的内容。例如,要在 worker 节点上配置 chrony,请创建一个99-worker-chrony.bu文件。注意如需有关 Butane 的信息,请参阅"使用 Butane 创建机器配置"。

variant: openshift version: 4.8.0 metadata: name: 99-worker-chrony1 labels: machineconfiguration.openshift.io/role: worker2 storage: files: - path: /etc/chrony.conf mode: 06443 overwrite: true contents: inline: | pool 0.rhel.pool.ntp.org iburst4 driftfile /var/lib/chrony/drift makestep 1.0 3 rtcsync logdir /var/log/chrony使用 Butane 生成

MachineConfig对象文件99-worker-chrony.yaml,其中包含要交付至节点的配置:$ butane 99-worker-chrony.bu -o 99-worker-chrony.yaml使用以下两种方式之一应用配置:

-

如果集群还没有运行,在生成清单文件后,将

MachineConfig对象文件添加到<installation_directory>/openshift目录中,然后继续创建集群。 如果集群已在运行,请应用该文件:

$ oc apply -f ./99-worker-chrony.yaml

-

如果集群还没有运行,在生成清单文件后,将

3.2.2. 为节点添加内核参数

在一些特殊情况下,您可能需要为集群中的一组节点添加内核参数。进行此操作时应小心谨慎,而且您必须先清楚了解所设参数的影响。

不当使用内核参数会导致系统变得无法引导。

您可以设置的内核参数示例包括:

- Enforcing=0:将 Security Enhanced Linux(SELinux)配置为以 permissive 模式运行。在 permissive 模式中,系统会象 enforcing 模式一样加载安全策略,包括标记对象并在日志中记录访问拒绝条目,但它并不会拒绝任何操作。虽然不建议在生产环境系统中使用 permissive 模式,但 permissive 模式会有助于调试。

-

nosmt:在内核中禁用对称多线程 (SMT)。多线程允许每个 CPU 有多个逻辑线程。您可以在多租户环境中考虑使用

nosmt,以减少潜在的跨线程攻击风险。禁用 SMT 在本质上相当于选择安全性而非性能。

如需内核参数的列表和描述,请参阅 Kernel.org 内核参数。

在以下流程中,您要创建一个用于标识以下内容的 MachineConfig 对象:

- 您要添加内核参数的一组机器。本例中为具有 worker 角色的机器。

- 附加到现有内核参数末尾的内核参数。

- 指示机器配置列表中应用更改的位置的标签。

先决条件

- 具有正常运行的 OpenShift Container Platform 集群的管理特权。

流程

列出 OpenShift Container Platform 集群的现有

MachineConfig对象,以确定如何标记您的机器配置:$ oc get MachineConfig输出示例

NAME GENERATEDBYCONTROLLER IGNITIONVERSION AGE 00-master 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 00-worker 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-master-container-runtime 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-master-kubelet 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-worker-container-runtime 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-worker-kubelet 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 99-master-generated-registries 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 99-master-ssh 3.2.0 40m 99-worker-generated-registries 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 99-worker-ssh 3.2.0 40m rendered-master-23e785de7587df95a4b517e0647e5ab7 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m rendered-worker-5d596d9293ca3ea80c896a1191735bb1 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m创建一个用于标识内核参数的

MachineConfig对象文件(例如05-worker-kernelarg-selinuxpermissive.yaml)apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: worker1 name: 05-worker-kernelarg-selinuxpermissive2 spec: config: ignition: version: 3.2.0 kernelArguments: - enforcing=03 创建新机器配置:

$ oc create -f 05-worker-kernelarg-selinuxpermissive.yaml检查机器配置以查看是否添加了新配置:

$ oc get MachineConfig输出示例

NAME GENERATEDBYCONTROLLER IGNITIONVERSION AGE 00-master 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 00-worker 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-master-container-runtime 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-master-kubelet 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-worker-container-runtime 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-worker-kubelet 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 05-worker-kernelarg-selinuxpermissive 3.2.0 105s 99-master-generated-registries 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 99-master-ssh 3.2.0 40m 99-worker-generated-registries 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 99-worker-ssh 3.2.0 40m rendered-master-23e785de7587df95a4b517e0647e5ab7 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m rendered-worker-5d596d9293ca3ea80c896a1191735bb1 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m检查节点:

$ oc get nodes输出示例

NAME STATUS ROLES AGE VERSION ip-10-0-136-161.ec2.internal Ready worker 28m v1.21.0 ip-10-0-136-243.ec2.internal Ready master 34m v1.21.0 ip-10-0-141-105.ec2.internal Ready,SchedulingDisabled worker 28m v1.21.0 ip-10-0-142-249.ec2.internal Ready master 34m v1.21.0 ip-10-0-153-11.ec2.internal Ready worker 28m v1.21.0 ip-10-0-153-150.ec2.internal Ready master 34m v1.21.0您可以发现,在应用更改时每个 worker 节点上的调度都会被禁用。

前往其中一个 worker 节点并列出内核命令行参数(主机上的

/proc/cmdline中),以检查内核参数确实已发挥作用:$ oc debug node/ip-10-0-141-105.ec2.internal输出示例

Starting pod/ip-10-0-141-105ec2internal-debug ... To use host binaries, run `chroot /host` sh-4.2# cat /host/proc/cmdline BOOT_IMAGE=/ostree/rhcos-... console=tty0 console=ttyS0,115200n8 rootflags=defaults,prjquota rw root=UUID=fd0... ostree=/ostree/boot.0/rhcos/16... coreos.oem.id=qemu coreos.oem.id=ec2 ignition.platform.id=ec2 enforcing=0 sh-4.2# exit您应看到

enforcing=0参数已添加至其他内核参数。

3.2.3. 在 RHCOS 上启用带有内核参数的多路径

Red Hat Enterprise Linux CoreOS (RHCOS) 支持主磁盘上的多路径,允许对硬件故障进行更强大的弹性,以实现更高的主机可用性。通过机器配置激活多路径,提供安装后支持。

对于在 OpenShift Container Platform 4.8 或更高版本中置备的节点,推荐在安装过程中启用多路径。在任何 I/O 到未优化路径会导致 I/O 系统错误的设置中,您必须在安装时启用多路径。有关在安装过程中启用多路径的更多信息,请参阅在裸机上安装中的 "使用 RHCOS 上内核参数启用多路径"。

在 IBM Z 和 LinuxONE 中,您只能在在安装过程中为它配置集群时启用多路径。如需更多信息,请参阅在 IBM Z 和 LinuxONE 上安装使用 z/VM 的集群"安装 RHCOS 并启动 OpenShift Container Platform bootstrap 过程"。

先决条件

- 您有一个正在运行的 OpenShift Container Platform 集群,它使用版本 4.7 或更高版本。

- 您以具有管理特权的用户身份登录集群。

流程

要在 control plane 节点上启用多路径安装后:

创建机器配置文件,如

99-master-kargs-mpath.yaml,该文件指示集群添加master标签并标识多路径内核参数,例如:apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: "master" name: 99-master-kargs-mpath spec: kernelArguments: - 'rd.multipath=default' - 'root=/dev/disk/by-label/dm-mpath-root'

在 worker 节点上启用多路径安装后:

创建机器配置文件,如

99-worker-kargs-mpath.yaml,该文件指示集群添加worker标签并标识多路径内核参数,例如:apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: "worker" name: 99-worker-kargs-mpath spec: kernelArguments: - 'rd.multipath=default' - 'root=/dev/disk/by-label/dm-mpath-root'

使用之前创建的 master 或 worker YAML 文件创建新机器配置:

$ oc create -f ./99-worker-kargs-mpath.yaml检查机器配置以查看是否添加了新配置:

$ oc get MachineConfig输出示例

NAME GENERATEDBYCONTROLLER IGNITIONVERSION AGE 00-master 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 00-worker 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-master-container-runtime 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-master-kubelet 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-worker-container-runtime 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 01-worker-kubelet 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 99-master-generated-registries 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 99-master-ssh 3.2.0 40m 99-worker-generated-registries 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m 99-worker-kargs-mpath 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 105s 99-worker-ssh 3.2.0 40m rendered-master-23e785de7587df95a4b517e0647e5ab7 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m rendered-worker-5d596d9293ca3ea80c896a1191735bb1 52dd3ba6a9a527fc3ab42afac8d12b693534c8c9 3.2.0 33m检查节点:

$ oc get nodes输出示例

NAME STATUS ROLES AGE VERSION ip-10-0-136-161.ec2.internal Ready worker 28m v1.20.0 ip-10-0-136-243.ec2.internal Ready master 34m v1.20.0 ip-10-0-141-105.ec2.internal Ready,SchedulingDisabled worker 28m v1.20.0 ip-10-0-142-249.ec2.internal Ready master 34m v1.20.0 ip-10-0-153-11.ec2.internal Ready worker 28m v1.20.0 ip-10-0-153-150.ec2.internal Ready master 34m v1.20.0您可以发现,在应用更改时每个 worker 节点上的调度都会被禁用。

前往其中一个 worker 节点并列出内核命令行参数(主机上的

/proc/cmdline中),以检查内核参数确实已发挥作用:$ oc debug node/ip-10-0-141-105.ec2.internal输出示例

Starting pod/ip-10-0-141-105ec2internal-debug ... To use host binaries, run `chroot /host` sh-4.2# cat /host/proc/cmdline ... rd.multipath=default root=/dev/disk/by-label/dm-mpath-root ... sh-4.2# exit您应看到添加的内核参数。

3.2.4. 在节点中添加实时内核

一些 OpenShift Container Platform 工作负载需要高度确定性。虽然 Linux 不是实时操作系统,但 Linux 实时内核包含一个抢占调度程序,它为操作系统提供实时特征。

如果您的 OpenShift Container Platform 工作负载需要这些实时特征,您可以将机器切换到 Linux 实时内核。对于 OpenShift Container Platform 4.8,您可以使用 MachineConfig 对象进行这个切换。虽然进行这个切换非常简单(只需要把机器配置的 kernelType 设置为 realtime),但进行更改前需要注意:

- 目前,实时内核只支持在 worker 节点上运行,且只支持无线电访问网络(RAN)使用。

- 使用为 Red Hat Enterprise Linux for Real Time 8 认证系统的裸机安装完全支持以下步骤。

- OpenShift Container Platform 中的实时支持仅限于特定的订阅。

- 以下流程也支持与 Google Cloud Platform 搭配使用。

先决条件

- 有一个正在运行的 OpenShift Container Platform 集群(版本 4.4 或更高版本)。

- 以具有管理特权的用户身份登录集群。

流程

为实时内核创建一个机器配置:创建一个 YAML 文件(例如,

99-worker-realtime.yaml),其中包含一个realtime内核类型的MachineConfig对象。本例告诉集群在所有 worker 节点中使用实时内核:$ cat << EOF > 99-worker-realtime.yaml apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: "worker" name: 99-worker-realtime spec: kernelType: realtime EOF将机器配置添加到集群。键入以下内容将机器配置添加到集群中:

$ oc create -f 99-worker-realtime.yaml检查实时内核: 每当受影响节点重新引导后,登录到集群,并运行以下命令来确保您配置的节点组中使用实时内核替换了常规内核:

$ oc get nodes输出示例

NAME STATUS ROLES AGE VERSION ip-10-0-143-147.us-east-2.compute.internal Ready worker 103m v1.21.0 ip-10-0-146-92.us-east-2.compute.internal Ready worker 101m v1.21.0 ip-10-0-169-2.us-east-2.compute.internal Ready worker 102m v1.21.0$ oc debug node/ip-10-0-143-147.us-east-2.compute.internal输出示例

Starting pod/ip-10-0-143-147us-east-2computeinternal-debug ... To use host binaries, run `chroot /host` sh-4.4# uname -a Linux <worker_node> 4.18.0-147.3.1.rt24.96.el8_1.x86_64 #1 SMP PREEMPT RT Wed Nov 27 18:29:55 UTC 2019 x86_64 x86_64 x86_64 GNU/Linux内核名称包含

rt和 "PREMPT RT" 来表示这是一个实时内核。要返回常规内核,请删除

MachineConfig对象:$ oc delete -f 99-worker-realtime.yaml

3.2.5. 配置 journald 设置

如果您需要在 OpenShift Container Platform 节点上配置 journald 服务设置,您可以修改适当的配置文件并将该文件作为机器配置传递给适当的节点池。

此流程描述了如何修改 /etc/systemd/journald.conf 文件中的 journald 限制设置并将其应用到 worker 节点。有关如何使用该文件的详情,请查看 journald.conf 手册页。

先决条件

- 有一个正在运行的 OpenShift Container Platform 集群。

- 以具有管理特权的用户身份登录集群。

流程

创建一个 Butane 配置文件

40-worker-custom-journald.bu,其中包含带有所需设置的/etc/systemd/journald.conf文件。注意有关 Butane 的信息,请参阅"使用 Butane 创建机器配置"。

variant: openshift version: 4.8.0 metadata: name: 40-worker-custom-journald labels: machineconfiguration.openshift.io/role: worker storage: files: - path: /etc/systemd/journald.conf mode: 0644 overwrite: true contents: inline: | # Disable rate limiting RateLimitInterval=1s RateLimitBurst=10000 Storage=volatile Compress=no MaxRetentionSec=30s使用 Butane 生成

MachineConfig对象文件40-worker-custom-journald.yaml,包含要发送到 worker 节点的配置:$ butane 40-worker-custom-journald.bu -o 40-worker-custom-journald.yaml将机器配置应用到池:

$ oc apply -f 40-worker-custom-journald.yaml检查是否应用新机器配置,并且节点是否处于降级状态。它可能需要几分钟时间。worker 池将显示更新进行中,每个节点都成功应用了新的机器配置:

$ oc get machineconfigpool NAME CONFIG UPDATED UPDATING DEGRADED MACHINECOUNT READYMACHINECOUNT UPDATEDMACHINECOUNT DEGRADEDMACHINECOUNT AGE master rendered-master-35 True False False 3 3 3 0 34m worker rendered-worker-d8 False True False 3 1 1 0 34m要检查是否应用了更改,您可以登录到 worker 节点:

$ oc get node | grep worker ip-10-0-0-1.us-east-2.compute.internal Ready worker 39m v0.0.0-master+$Format:%h$ $ oc debug node/ip-10-0-0-1.us-east-2.compute.internal Starting pod/ip-10-0-141-142us-east-2computeinternal-debug ... ... sh-4.2# chroot /host sh-4.4# cat /etc/systemd/journald.conf # Disable rate limiting RateLimitInterval=1s RateLimitBurst=10000 Storage=volatile Compress=no MaxRetentionSec=30s sh-4.4# exit

3.2.6. 为 RHCOS 添加扩展

RHCOS 是基于容器的最小 RHEL 操作系统,旨在为所有平台的 OpenShift Container Platform 集群提供一组通用的功能。通常不建议在 RHCOS 系统中添加软件软件包,但 MCO 提供了一个 extensions(扩展) 功能,您可以使用 MCO 为 RHCOS 节点添加一组最小的功能。

目前,提供了以下扩展程序:

-

usbguard:添加

usbguard扩展可保护 RHCOS 系统不受入侵 USB 设备的攻击。详情请查看 USBGuard。

以下流程描述了如何使用机器配置为 RHCOS 节点添加一个或多个扩展。

先决条件

- 有一个正在运行的 OpenShift Container Platform 集群(版本 4.6 或更高版本)。

- 以具有管理特权的用户身份登录集群。

流程

为扩展创建机器配置:创建一个 YAML 文件(如

80-extensions.yaml),其中包含MachineConfigextensions对象。本例告诉集群添加usbguard扩展。$ cat << EOF > 80-extensions.yaml apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: worker name: 80-worker-extensions spec: config: ignition: version: 3.2.0 extensions: - usbguard EOF将机器配置添加到集群。键入以下内容将机器配置添加到集群中:

$ oc create -f 80-extensions.yaml这会将所有 worker 节点设置为安装

usbguard的 rpm 软件包。检查是否应用了扩展:

$ oc get machineconfig 80-worker-extensions输出示例

NAME GENERATEDBYCONTROLLER IGNITIONVERSION AGE 80-worker-extensions 3.2.0 57s检查是否应用新机器配置,并且节点是否处于降级状态。它可能需要几分钟时间。worker 池将显示更新进行中,每台机器都成功应用了新机器配置:

$ oc get machineconfigpool输出示例

NAME CONFIG UPDATED UPDATING DEGRADED MACHINECOUNT READYMACHINECOUNT UPDATEDMACHINECOUNT DEGRADEDMACHINECOUNT AGE master rendered-master-35 True False False 3 3 3 0 34m worker rendered-worker-d8 False True False 3 1 1 0 34m检查扩展。要检查是否应用了扩展,请运行:

$ oc get node | grep worker输出示例

NAME STATUS ROLES AGE VERSION ip-10-0-169-2.us-east-2.compute.internal Ready worker 102m v1.18.3$ oc debug node/ip-10-0-169-2.us-east-2.compute.internal输出示例

... To use host binaries, run `chroot /host` sh-4.4# chroot /host sh-4.4# rpm -q usbguard usbguard-0.7.4-4.el8.x86_64.rpm

3.2.7. 在机器配置清单中载入自定义固件 Blob

因为 /usr/lib 中固件 Blob 的默认位置是只读的,所以您可以通过更新搜索路径来查找自定义固件 Blob。这可让您在 RHCOS 不管理 blob 时载入机器配置清单中的本地固件 Blob。

流程

创建 Butane 配置文件

98-worker-firmware-blob.bu,它会更新搜索路径,以便其为 root 所有且对本地存储可写。以下示例将本地工作站的自定义 blob 文件放在/var/lib/firmware下的节点上。注意有关 Butane 的信息,请参阅"使用 Butane 创建机器配置"。

自定义固件 blob 的 Butane 配置文件

variant: openshift version: 4.9.0 metadata: labels: machineconfiguration.openshift.io/role: worker name: 98-worker-firmware-blob storage: files: - path: /var/lib/firmware/<package_name>1 contents: local: <package_name>2 mode: 06443 openshift: kernel_arguments: - 'firmware_class.path=/var/lib/firmware'4 运行 Butane 生成

MachineConfig对象文件,该文件使用名为98-worker-firmware-blob.yaml的本地工作站中的固件 blob 副本。固件 blob 包含要传送到节点的配置。以下示例使用--files-dir选项指定工作站上本地文件或目录所在的目录:$ butane 98-worker-firmware-blob.bu -o 98-worker-firmware-blob.yaml --files-dir <directory_including_package_name>通过两种方式之一将配置应用到节点:

-

如果集群还没有运行,在生成清单文件后,将

MachineConfig对象文件添加到<installation_directory>/openshift目录中,然后继续创建集群。 如果集群已在运行,请应用该文件:

$ oc apply -f 98-worker-firmware-blob.yaml已为您创建一个

MachineConfig对象 YAML 文件,以完成机器的配置。

-

如果集群还没有运行,在生成清单文件后,将

-

如果将来需要更新

MachineConfig对象,请保存 Butane 配置。

3.3. 配置 MCO 相关的自定义资源

除了管理 MachineConfig 对象外,MCO 管理两个自定义资源(CR):KubeletConfig 和 ContainerRuntimeConfig。这些 CR 可让您更改节点级别的设置,这会影响到 Kubelet 和 CRI-O 容器运行时服务的行为。

3.3.1. 创建 KubeletConfig CRD 来编辑 kubelet 参数

kubelet 配置目前被序列化为 Ignition 配置,因此可以直接编辑。但是,在 Machine Config Controller (MCC) 中同时添加了新的 kubelet-config-controller 。这可让您使用 KubeletConfig 自定义资源 (CR) 来编辑 kubelet 参数。

因为 kubeletConfig 对象中的字段直接从上游 Kubernetes 传递给 kubelet,kubelet 会直接验证这些值。kubeletConfig 对象中的无效值可能会导致集群节点不可用。有关有效值,请参阅 Kubernetes 文档。

请考虑以下指导:

-

为每个机器配置池创建一个

KubeletConfigCR,带有该池需要更改的所有配置。如果要将相同的内容应用到所有池,则所有池仅需要一个KubeletConfigCR。 -

编辑现有的

KubeletConfigCR 以修改现有设置或添加新设置,而不是为每个更改创建一个 CR。建议您仅创建一个 CR 来修改不同的机器配置池,或用于临时更改,以便您可以恢复更改。 -

根据需要,创建多个

KubeletConfigCR,每个集群限制为 10。对于第一个KubeletConfigCR,Machine Config Operator (MCO) 会创建一个机器配置,并附带kubelet。对于每个后续 CR,控制器会创建另一个带有数字后缀的kubelet机器配置。例如,如果您有一个带有-2后缀的kubelet机器配置,则下一个kubelet机器配置会附加-3。

如果要删除机器配置,以相反的顺序删除它们,以避免超过限制。例如,在删除 kubelet-2 机器配置前删除 kubelet-3 机器配置。

如果您有一个带有 kubelet-9 后缀的机器配置,并且创建了另一个 KubeletConfig CR,则不会创建新的机器配置,即使少于 10 个 kubelet 机器配置。

KubeletConfig CR 示例

$ oc get kubeletconfigNAME AGE

set-max-pods 15m显示 KubeletConfig 机器配置示例

$ oc get mc | grep kubelet...

99-worker-generated-kubelet-1 b5c5119de007945b6fe6fb215db3b8e2ceb12511 3.2.0 26m

...以下流程演示了如何配置 worker 节点上的每个节点的最大 pod 数量。

先决条件

为您要配置的节点类型获取与静态

MachineConfigPoolCR 关联的标签。执行以下步骤之一:查看机器配置池:

$ oc describe machineconfigpool <name>例如:

$ oc describe machineconfigpool worker输出示例

apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfigPool metadata: creationTimestamp: 2019-02-08T14:52:39Z generation: 1 labels: custom-kubelet: set-max-pods1 - 1

- 如果添加了标签,它会出现在

labels下。

如果标签不存在,则添加一个键/值对:

$ oc label machineconfigpool worker custom-kubelet=set-max-pods

流程

查看您可以选择的可用机器配置对象:

$ oc get machineconfig默认情况下,与 kubelet 相关的配置为

01-master-kubelet和01-worker-kubelet。检查每个节点的最大 pod 的当前值:

$ oc describe node <node_name>例如:

$ oc describe node ci-ln-5grqprb-f76d1-ncnqq-worker-a-mdv94在

Allocatable小节中找到value: pods: <value>:输出示例

Allocatable: attachable-volumes-aws-ebs: 25 cpu: 3500m hugepages-1Gi: 0 hugepages-2Mi: 0 memory: 15341844Ki pods: 250通过创建一个包含 kubelet 配置的自定义资源文件,设置 worker 节点上的每个节点的最大 pod:

apiVersion: machineconfiguration.openshift.io/v1 kind: KubeletConfig metadata: name: set-max-pods spec: machineConfigPoolSelector: matchLabels: custom-kubelet: set-max-pods1 kubeletConfig: maxPods: 5002 注意kubelet 与 API 服务器进行交互的频率取决于每秒的查询数量 (QPS) 和 burst 值。如果每个节点上运行的 pod 数量有限,使用默认值(

kubeAPIQPS为50,kubeAPIBurst为100)就可以。如果节点上有足够 CPU 和内存资源,则建议更新 kubelet QPS 和 burst 速率。apiVersion: machineconfiguration.openshift.io/v1 kind: KubeletConfig metadata: name: set-max-pods spec: machineConfigPoolSelector: matchLabels: custom-kubelet: set-max-pods kubeletConfig: maxPods: <pod_count> kubeAPIBurst: <burst_rate> kubeAPIQPS: <QPS>为带有标签的 worker 更新机器配置池:

$ oc label machineconfigpool worker custom-kubelet=large-pods创建

KubeletConfig对象:$ oc create -f change-maxPods-cr.yaml验证

KubeletConfig对象是否已创建:$ oc get kubeletconfig输出示例

NAME AGE set-max-pods 15m根据集群中的 worker 节点数量,等待每个 worker 节点被逐个重启。对于有 3 个 worker 节点的集群,这个过程可能需要大约 10 到 15 分钟。

验证更改是否已应用到节点:

在 worker 节点上检查

maxPods值已更改:$ oc describe node <node_name>找到

Allocatable小节:... Allocatable: attachable-volumes-gce-pd: 127 cpu: 3500m ephemeral-storage: 123201474766 hugepages-1Gi: 0 hugepages-2Mi: 0 memory: 14225400Ki pods: 5001 ...- 1

- 在本例中,

pods参数应报告您在KubeletConfig对象中设置的值。

验证

KubeletConfig对象中的更改:$ oc get kubeletconfigs set-max-pods -o yaml这应该会显示

status: "True"和type:Success:spec: kubeletConfig: maxPods: 500 machineConfigPoolSelector: matchLabels: custom-kubelet: set-max-pods status: conditions: - lastTransitionTime: "2021-06-30T17:04:07Z" message: Success status: "True" type: Success

3.3.2. 创建 ContainerRuntimeConfig CR 以编辑 CRI-O 参数

您可以为与特定机器配置池(MCP)关联的节点更改与 OpenShift Container Platform CRI-O 运行时关联的一些设置。通过使用 ContainerRuntimeConfig 自定义资源(CR),您可以设置配置值并添加一个标签以匹配 MCP。然后,MCO 会使用更新的值重建关联节点上的 crio.conf 和 storage.conf 配置文件。

要使用 ContainerRuntimeConfig CR 恢复实现的更改,您必须删除 CR。从机器配置池中删除标签不会恢复更改。

您可以使用 ContainerRuntimeConfig CR 修改以下设置:

-

PIDs limit:

pidsLimit参数设置 CRI-Opids_limit参数,这是容器中允许的最大进程数。默认为 1024(pids_limit = 1024)。 -

日志级别:

logLevel参数设置 CRI-Olog_level参数,即日志消息的详细程度。默认为info(log_level = info)。其他选项包括fatal、panic、error、warn、debug和trace。 -

Overlay 大小:

overlaySize参数设置 CRI-O Overlay 存储驱动程序size参数,这是容器镜像的最大大小。 -

最大日志大小:

logSizeMax参数设置 CRI-Olog_size_max参数,这是容器日志文件允许的最大值。默认为没有限制(log_size_max = -1)。如果设置为正数,则必须至少小于 ConMon 读取缓冲的 8192。conMon 是一个监控单个容器管理器(如 Podman 或 CRI-O)与 OCI 运行时(如 runc 或 crun)之间的通信的程序。

您应该为每个机器配置池有一个ContainerRuntimeConfig CR,并为该池分配所有配置更改。如果要将相同的内容应用到所有池,则所有池只需要 oneContainerRuntimeConfig CR。

您应该编辑现有的 ContainerRuntimeConfig CR,以修改现有设置或添加新设置,而不是为每个更改创建新 CR。建议您只创建一个新的 ContainerRuntimeConfig CR 来修改不同的机器配置池,或者用于临时的更改,以便您可以恢复更改。

您可以根据需要创建多个 ContainerRuntimeConfig CR,每个集群的限制为 10。对于第一个 ContainerRuntimeConfig CR,MCO 会创建一个机器配置并附加 containerruntime。对于每个后续 CR,控制器会创建一个带有数字后缀的新 containerruntime 机器配置。例如,如果您有一个带有 -2 后缀的 containerruntime 机器配置,则下一个 containerruntime 机器配置会附加 -3。

如果要删除机器配置,应该以相反的顺序删除它们,以避免超过限制。例如,您应该在删除 containerruntime-2 机器配置前删除 containerruntime-3 机器配置。

如果您的机器配置带有 containerruntime-9 后缀,并且创建了 anotherContainerRuntimeConfig CR,则不会创建新的机器配置,即使少于 10 个 containerruntime 机器配置。

显示多个 ContainerRuntimeConfig CR 示例

$ oc get ctrcfg输出示例

NAME AGE

ctr-pid 24m

ctr-overlay 15m

ctr-level 5m45s显示多个 containerruntime 机器配置示例

$ oc get mc | grep container输出示例

...

01-master-container-runtime b5c5119de007945b6fe6fb215db3b8e2ceb12511 3.2.0 57m

...

01-worker-container-runtime b5c5119de007945b6fe6fb215db3b8e2ceb12511 3.2.0 57m

...

99-worker-generated-containerruntime b5c5119de007945b6fe6fb215db3b8e2ceb12511 3.2.0 26m

99-worker-generated-containerruntime-1 b5c5119de007945b6fe6fb215db3b8e2ceb12511 3.2.0 17m

99-worker-generated-containerruntime-2 b5c5119de007945b6fe6fb215db3b8e2ceb12511 3.2.0 7m26s

...

以下示例将 pids_limit 增加到 2048,将 log_level 设置为 debug,将覆盖大小设置为 8 GB,并将 log_size_max 设置为无限:

ContainerRuntimeConfig CR 示例

apiVersion: machineconfiguration.openshift.io/v1

kind: ContainerRuntimeConfig

metadata:

name: overlay-size

spec:

machineConfigPoolSelector:

matchLabels:

pools.operator.machineconfiguration.openshift.io/worker: ''

containerRuntimeConfig:

pidsLimit: 2048

logLevel: debug

overlaySize: 8G

logSizeMax: "-1" 流程

使用 ContainerRuntimeConfig CR 更改 CRI-O 设置:

为

ContainerRuntimeConfigCR 创建 YAML 文件:apiVersion: machineconfiguration.openshift.io/v1 kind: ContainerRuntimeConfig metadata: name: overlay-size spec: machineConfigPoolSelector: matchLabels: pools.operator.machineconfiguration.openshift.io/worker: ''1 containerRuntimeConfig:2 pidsLimit: 2048 logLevel: debug overlaySize: 8G logSizeMax: "-1"创建

ContainerRuntimeConfigCR:$ oc create -f <file_name>.yaml验证是否已创建 CR:

$ oc get ContainerRuntimeConfig输出示例

NAME AGE overlay-size 3m19s检查是否创建了新的

containerruntime机器配置:$ oc get machineconfigs | grep containerrun输出示例

99-worker-generated-containerruntime 2c9371fbb673b97a6fe8b1c52691999ed3a1bfc2 3.2.0 31s监控机器配置池,直到所有系统都显示为 ready 状态:

$ oc get mcp worker输出示例

NAME CONFIG UPDATED UPDATING DEGRADED MACHINECOUNT READYMACHINECOUNT UPDATEDMACHINECOUNT DEGRADEDMACHINECOUNT AGE worker rendered-worker-169 False True False 3 1 1 0 9h验证设置是否在 CRI-O 中应用:

打开到机器配置池中节点的

oc debug会话,并运行chroot /host。$ oc debug node/<node_name>sh-4.4# chroot /host验证

crio.conf文件中的更改:sh-4.4# crio config | egrep 'log_level|pids_limit|log_size_max'输出示例

pids_limit = 2048 log_size_max = -1 log_level = "debug"验证 'storage.conf' 文件中的更改:

sh-4.4# head -n 7 /etc/containers/storage.conf输出示例

[storage] driver = "overlay" runroot = "/var/run/containers/storage" graphroot = "/var/lib/containers/storage" [storage.options] additionalimagestores = [] size = "8G"

3.3.3. 使用 CRI-O 为 Overlay 设置默认的最大容器根分区大小

每个容器的根分区显示底层主机的所有可用磁盘空间。按照以下说明,为所有容器的 root 磁盘设置最大分区大小。

要配置最大 Overlay 大小,以及其他 CRI-O 选项,如日志级别和 PID 限制,您可以创建以下 ContainerRuntimeConfig 自定义资源定义(CRD):

apiVersion: machineconfiguration.openshift.io/v1

kind: ContainerRuntimeConfig

metadata:

name: overlay-size

spec:

machineConfigPoolSelector:

matchLabels:

custom-crio: overlay-size

containerRuntimeConfig:

pidsLimit: 2048

logLevel: debug

overlaySize: 8G流程

创建配置对象:

$ oc apply -f overlaysize.yml要将新的 CRI-O 配置应用到 worker 节点,请编辑 worker 机器配置池:

$ oc edit machineconfigpool worker根据在

ContainerRuntimeConfigCRD 中设置的matchLabels名称添加custom-crio标签:apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfigPool metadata: creationTimestamp: "2020-07-09T15:46:34Z" generation: 3 labels: custom-crio: overlay-size machineconfiguration.openshift.io/mco-built-in: ""保存更改,然后查看机器配置:

$ oc get machineconfigs新的

99-worker-generated-containerruntime和rendered-worker-xyz对象被创建:输出示例

99-worker-generated-containerruntime 4173030d89fbf4a7a0976d1665491a4d9a6e54f1 3.2.0 7m42s rendered-worker-xyz 4173030d89fbf4a7a0976d1665491a4d9a6e54f1 3.2.0 7m36s创建这些对象后,监控机器配置池以了解要应用的更改:

$ oc get mcp workerworker 节点将

UPDATING显示为True,以及机器数量、更新的数字和其他详情:输出示例

NAME CONFIG UPDATED UPDATING DEGRADED MACHINECOUNT READYMACHINECOUNT UPDATEDMACHINECOUNT DEGRADEDMACHINECOUNT AGE worker rendered-worker-xyz False True False 3 2 2 0 20h完成后,worker 节点会从

UPDATING转换回False,UPDATEDMACHINECOUNT数与MACHINECOUNT数匹配:输出示例

NAME CONFIG UPDATED UPDATING DEGRADED MACHINECOUNT READYMACHINECOUNT UPDATEDMACHINECOUNT DEGRADEDMACHINECOUNT AGE worker rendered-worker-xyz True False False 3 3 3 0 20h查看 worker 机器,您会看到新的 8 GB 最大大小配置适用于所有 worker:

输出示例

head -n 7 /etc/containers/storage.conf [storage] driver = "overlay" runroot = "/var/run/containers/storage" graphroot = "/var/lib/containers/storage" [storage.options] additionalimagestores = [] size = "8G"在容器内,您会看到 root 分区现在为 8 GB:

输出示例

~ $ df -h Filesystem Size Used Available Use% Mounted on overlay 8.0G 8.0K 8.0G 0% /

第 4 章 安装后集群任务

安装 OpenShift Container Platform 后,您可以按照自己的要求进一步扩展和自定义集群。

4.1. 可用的集群自定义

大多数集群配置和自定义在 OpenShift Container Platform 集群部署后完成。有若干配置资源可用。

如果在 IBM Z 上安装集群,则不是所有功能都可用。

您可以修改配置资源来配置集群的主要功能,如镜像 registry、网络配置、镜像构建操作以及用户身份供应商。

如需设置这些资源的当前信息,请使用 oc explain 命令,如 oc explain builds --api-version=config.openshift.io/v1

4.1.1. 集群配置资源

所有集群配置资源都作用于全局范围(而非命名空间),且命名为 cluster。

| 资源名称 | 描述 |

|---|---|

|

| 提供 API 服务器配置,如证书和证书颁发机构。 |

|

| 控制集群的身份提供程序和身份验证配置。 |

|

| 控制集群中所有构建的默认和强制配置。 |

|

| 配置 Web 控制台界面的行为,包括注销行为。 |

|

| 启用 FeatureGates,以便您能使用技术预览功能。 |

|

| 配置应如何对待特定的镜像 registry(允许、禁用、不安全、CA 详情)。 |

|

| 与路由相关的配置详情,如路由 的默认域。 |

|

| 配置用户身份供应商,以及与内部 OAuth 服务器流程相关的其他行为。 |

|

| 配置项目的创建方式,包括项目模板。 |

|

| 定义需要外部网络访问的组件要使用的代理。注意:目前不是所有组件都会消耗这个值。 |

|

| 配置调度程序行为,如策略和默认节点选择器。 |

4.1.2. Operator 配置资源

这些配置资源是集群范围的实例,即 cluster,控制归特定 Operator 所有的特定组件的行为。

| 资源名称 | 描述 |

|---|---|

|

| 控制控制台外观,如品牌定制 |

|

| 配置内部镜像 registry 设置,如公共路由、日志级别、代理设置、资源约束、副本数和存储类型。 |

|

| 配置 Samples Operator,以控制在集群上安装哪些镜像流和模板示例。 |

4.1.3. 其他配置资源

这些配置资源代表一个特定组件的单一实例。在有些情况下,您可以通过创建多个资源实例来请求多个实例。在其他情况下,Operator 只消耗指定命名空间中的特定资源实例名称。如需有关如何和何时创建其他资源实例的详情,请参考具体组件的文档。

| 资源名称 | 实例名称 | 命名空间 | 描述 |

|---|---|---|---|

|

|

|

| 控制 Alertmanager 部署参数。 |

|

|

|

| 配置 Ingress Operator 行为,如域、副本数、证书和控制器放置。 |

4.1.4. 信息资源

可以使用这些资源检索集群信息。有些配置可能需要您直接编辑这些资源。

| 资源名称 | 实例名称 | 描述 |

|---|---|---|

|

|

|

在 OpenShift Container Platform 4.8 中,不得自定义生产集群的 |

|

|

| 无法修改集群的 DNS 设置。您可以查看 DNS Operator 状态。 |

|

|

| 允许集群与其云供应商交互的配置详情。 |

|

|

| 无法在安装后修改集群网络。要自定义您的网络,请按照流程在安装过程中自定义网络。 |

4.2. 更新全局集群 pull secret

您可以通过替换当前的 pull secret 或附加新的 pull secret 来更新集群的全局 pull secret。

当用户使用单独的 registry 存储镜像而不使用安装过程中的 registry时,需要这个过程。

先决条件

-

您可以使用具有

cluster-admin角色的用户访问集群。

流程

可选: 要将新的 pull secret 附加到现有 pull secret 中,请完成以下步骤:

输入以下命令下载 pull secret:

$ oc get secret/pull-secret -n openshift-config --template='{{index .data ".dockerconfigjson" | base64decode}}' ><pull_secret_location>1 - 1

- 提供 pull secret 文件的路径。

输入以下命令来添加新 pull secret:

$ oc registry login --registry="<registry>" \1 --auth-basic="<username>:<password>" \2 --to=<pull_secret_location>3 另外,您可以对 pull secret 文件执行手动更新。

输入以下命令为您的集群更新全局 pull secret:

$ oc set data secret/pull-secret -n openshift-config --from-file=.dockerconfigjson=<pull_secret_location>1 - 1

- 提供新 pull secret 文件的路径。

该更新将推广至所有节点,可能需要一些时间,具体取决于集群大小。

注意从 OpenShift Container Platform 4.7.4 开始,对全局 pull secret 的更改不再触发节点排空或重启。

4.3. 调整 worker 节点

如果您在部署过程中错误地定义了 worker 节点的大小,可以通过创建一个或多个新机器集来调整它们,先对它们进行扩展,并缩小原始的机器集,然后再删除它们。

4.3.1. 了解机器集和机器配置池之间的区别

MachineSet 对象描述了与云或机器供应商相关的 OpenShift Container Platform 节点。

MachineConfigPool 对象允许 MachineConfigController 组件在升级过程中定义并提供机器的状态。

MachineConfigPool 对象允许用户配置如何将升级应用到机器配置池中的 OpenShift Container Platform 节点。

NodeSelector 对象可以被一个到 MachineSet 对象的引用替换。

4.3.2. 手动扩展机器集

要在机器集中添加或删除机器实例,您可以手动扩展机器集。

这个指南与全自动的、安装程序置备的基础架构安装相关。自定义的、用户置备的基础架构安装没有机器集。

先决条件

-

安装 OpenShift Container Platform 集群和

oc命令行。 -

以具有

cluster-admin权限的用户身份登录oc。

流程

查看集群中的机器集:

$ oc get machinesets -n openshift-machine-api机器集以

<clusterid>-worker-<aws-region-az>的形式列出。查看集群中的机器:

$ oc get machine -n openshift-machine-api在您要删除的机器上设置注解:

$ oc annotate machine/<machine_name> -n openshift-machine-api machine.openshift.io/cluster-api-delete-machine="true"进行 cordon 操作,排空您要删除的节点:

$ oc adm cordon <node_name> $ oc adm drain <node_name>扩展机器集:

$ oc scale --replicas=2 machineset <machineset> -n openshift-machine-api或者:

$ oc edit machineset <machineset> -n openshift-machine-api提示您还可以应用以下 YAML 来扩展机器集:

apiVersion: machine.openshift.io/v1beta1 kind: MachineSet metadata: name: <machineset> namespace: openshift-machine-api spec: replicas: 2您可以扩展或缩减机器集。需要过几分钟以后新机器才可用。

验证

验证删除预期的机器:

$ oc get machines

4.3.3. 机器集删除策略

Random、Newest 和 Oldest 是三个支持的删除选项。默认值为 Random,表示在扩展机器时随机选择并删除机器。通过修改特定机器集,可以根据用例设置删除策略:

spec:

deletePolicy: <delete_policy>

replicas: <desired_replica_count>

无论删除策略是什么,都可通过在相关机器上添加 machine.openshift.io/cluster-api-delete-machine=true 注解来指定机器删除的优先级。

默认情况下,OpenShift Container Platform 路由器 Pod 部署在 worker 上。由于路由器需要访问某些集群资源(包括 Web 控制台),除非先重新放置了路由器 Pod,否则请不要将 worker 机器集扩展为 0。

当用户需要特定的服务必须运行在特定节点,在 worker 机器集进行缩减时需要忽略这些服务时,可以使用自定义机器集。这可防止服务被中断。

4.3.4. 创建默认的集群范围节点选择器

您可以组合使用 pod 上的默认集群范围节点选择器和节点上的标签,将集群中创建的所有 pod 限制到特定节点。

使用集群范围节点选择器时,如果您在集群中创建 pod,OpenShift Container Platform 会将默认节点选择器添加到 pod,并将该 pod 调度到具有匹配标签的节点。

您可以通过编辑调度程序 Operator 自定义资源(CR)来配置集群范围节点选择器。您可为节点、机器集或机器配置添加标签。将标签添加到机器集可确保节点或机器停机时,新节点具有标签。如果节点或机器停机,添加到节点或机器配置的标签不会保留。

您可以向 pod 添加额外的键/值对。但是,您无法为一个默认的键添加不同的值。

流程

添加默认的集群范围节点选择器:

编辑调度程序 Operator CR 以添加默认的集群范围节点选择器:

$ oc edit scheduler cluster使用节点选择器的调度程序 Operator CR 示例

apiVersion: config.openshift.io/v1 kind: Scheduler metadata: name: cluster ... spec: defaultNodeSelector: type=user-node,region=east1 mastersSchedulable: false policy: name: ""- 1

- 使用适当的

<key>:<value>对添加节点选择器。

完成此更改后,请等待重新部署

openshift-kube-apiserver项目中的 pod。这可能需要几分钟。只有重新部署 pod 后,默认的集群范围节点选择器才会生效。通过使用机器集或直接编辑节点,为节点添加标签:

在创建节点时,使用机器集向由机器集管理的节点添加标签:

运行以下命令,将标签添加到

MachineSet对象中:$ oc patch MachineSet <name> --type='json' -p='[{"op":"add","path":"/spec/template/spec/metadata/labels", "value":{"<key>"="<value>","<key>"="<value>"}}]' -n openshift-machine-api1 - 1

- 为每个标识添加

<key>/<value>对。

例如:

$ oc patch MachineSet ci-ln-l8nry52-f76d1-hl7m7-worker-c --type='json' -p='[{"op":"add","path":"/spec/template/spec/metadata/labels", "value":{"type":"user-node","region":"east"}}]' -n openshift-machine-api提示您还可以应用以下 YAML 来向机器集中添加标签:

apiVersion: machine.openshift.io/v1beta1 kind: MachineSet metadata: name: <machineset> namespace: openshift-machine-api spec: template: spec: metadata: labels: region: "east" type: "user-node"使用

oc edit命令验证标签是否已添加到MachineSet对象中:例如:

$ oc edit MachineSet abc612-msrtw-worker-us-east-1c -n openshift-machine-apiMachineSet对象示例apiVersion: machine.openshift.io/v1beta1 kind: MachineSet ... spec: ... template: metadata: ... spec: metadata: labels: region: east type: user-node ...通过缩减至

0并扩展节点来重新部署与该机器集关联的节点:例如:

$ oc scale --replicas=0 MachineSet ci-ln-l8nry52-f76d1-hl7m7-worker-c -n openshift-machine-api$ oc scale --replicas=1 MachineSet ci-ln-l8nry52-f76d1-hl7m7-worker-c -n openshift-machine-api当节点就绪并可用时,使用

oc get命令验证该标签是否已添加到节点:$ oc get nodes -l <key>=<value>例如:

$ oc get nodes -l type=user-node输出示例

NAME STATUS ROLES AGE VERSION ci-ln-l8nry52-f76d1-hl7m7-worker-c-vmqzp Ready worker 61s v1.18.3+002a51f

直接向节点添加标签:

为节点编辑

Node对象:$ oc label nodes <name> <key>=<value>例如,若要为以下节点添加标签:

$ oc label nodes ci-ln-l8nry52-f76d1-hl7m7-worker-b-tgq49 type=user-node region=east提示您还可以应用以下 YAML 来向节点添加标签:

kind: Node apiVersion: v1 metadata: name: <node_name> labels: type: "user-node" region: "east"使用

oc get命令验证标签是否已添加到节点:$ oc get nodes -l <key>=<value>,<key>=<value>例如:

$ oc get nodes -l type=user-node,region=east输出示例

NAME STATUS ROLES AGE VERSION ci-ln-l8nry52-f76d1-hl7m7-worker-b-tgq49 Ready worker 17m v1.18.3+002a51f

4.4. 为生产环境创建基础架构机器集

您可以创建一个机器集来创建仅托管基础架构组件的机器,如默认路由器、集成的容器镜像 registry 和组件用于集群指标和监控。这些基础架构机器不会被计算为运行环境所需的订阅总数。

在生产部署中,建议您至少部署三个机器集来容纳基础架构组件。OpenShift Logging 和 Red Hat OpenShift Service Mesh 部署 Elasticsearch,这需要三个实例安装到不同的节点上。这些节点都可以部署到不同的可用区以实现高可用性。这样的配置需要三个不同的机器集,每个可用区都有一个。在没有多个可用区的全局 Azure 区域,您可以使用可用性集来确保高可用性。

有关基础架构节点以及可在基础架构节点上运行的组件的详情,请参考 创建基础架构机器集。

要创建基础架构节点,您可以使用机器集、post_installation_configuration/cluster-tasks.adoc#creating-an-infra-node_post-install-cluster-tasks[assign a label to the nodes] ,或使用机器配置池。

有关可用于这些流程的机器集示例,请参阅为不同的云创建机器集。

将特定节点选择器应用到所有基础架构组件会导致 OpenShift Container Platform 使用 该标签将这些工作负载调度到具有该标签的节点。

4.4.1. 创建机器集

除了安装程序创建的机器集之外,还可创建自己的机器集来动态管理您选择的特定工作负载的机器计算资源。

先决条件

- 部署一个 OpenShift Container Platform 集群。

-

安装 OpenShift CLI(

oc)。 -

以具有

cluster-admin权限的用户身份登录oc。

流程

创建一个包含机器集自定义资源(CR)示例的新 YAML 文件,并将其命名为

<file_name>.yaml。确保设置

<clusterID>和<role>参数值。如果您不确定要为特定字段设置哪个值,您可以从集群中检查现有机器集:

$ oc get machinesets -n openshift-machine-api输出示例

NAME DESIRED CURRENT READY AVAILABLE AGE agl030519-vplxk-worker-us-east-1a 1 1 1 1 55m agl030519-vplxk-worker-us-east-1b 1 1 1 1 55m agl030519-vplxk-worker-us-east-1c 1 1 1 1 55m agl030519-vplxk-worker-us-east-1d 0 0 55m agl030519-vplxk-worker-us-east-1e 0 0 55m agl030519-vplxk-worker-us-east-1f 0 0 55m检查特定机器集的值:

$ oc get machineset <machineset_name> -n \ openshift-machine-api -o yaml输出示例

... template: metadata: labels: machine.openshift.io/cluster-api-cluster: agl030519-vplxk1 machine.openshift.io/cluster-api-machine-role: worker2 machine.openshift.io/cluster-api-machine-type: worker machine.openshift.io/cluster-api-machineset: agl030519-vplxk-worker-us-east-1a

创建新的

MachineSetCR:$ oc create -f <file_name>.yaml查看机器集列表:

$ oc get machineset -n openshift-machine-api输出示例

NAME DESIRED CURRENT READY AVAILABLE AGE agl030519-vplxk-infra-us-east-1a 1 1 1 1 11m agl030519-vplxk-worker-us-east-1a 1 1 1 1 55m agl030519-vplxk-worker-us-east-1b 1 1 1 1 55m agl030519-vplxk-worker-us-east-1c 1 1 1 1 55m agl030519-vplxk-worker-us-east-1d 0 0 55m agl030519-vplxk-worker-us-east-1e 0 0 55m agl030519-vplxk-worker-us-east-1f 0 0 55m当新机器集可用时,

DESIRED和CURRENT的值会匹配。如果机器集不可用,请等待几分钟,然后再次运行命令。

4.4.2. 创建基础架构节点

请参阅为安装程序置备的基础架构环境创建基础架构机器集,或为 control plane 节点(也称为 master 节点)由机器 API 管理的任何集群创建基础架构机器集。

集群的基础架构系统(也称为 infra 节点)的要求已被置备。安装程序只为 control plane 和 worker 节点提供置备。Worker 节点可以通过标记来指定为基础架构节点或应用程序(也称为 app )。

流程

向您要充当应用程序节点的 worker 节点添加标签:

$ oc label node <node-name> node-role.kubernetes.io/app=""向您要充当基础架构节点的 worker 节点添加标签:

$ oc label node <node-name> node-role.kubernetes.io/infra=""检查相关节点现在是否具有

infra角色或app角色:$ oc get nodes创建默认的集群范围节点选择器。默认节点选择器应用到在所有命名空间中创建的 pod。这会创建一个与 pod 上任何现有节点选择器交集的交集,这会额外限制 pod 的选择器。

重要如果默认节点选择器键与 pod 标签的键冲突,则不会应用默认节点选择器。

但是,不要设置可能会导致 pod 变得不可调度的默认节点选择器。例如,当 pod 的标签被设置为不同的节点角色(如

node-role.kubernetes.io/infra="")时,将默认节点选择器设置为特定的节点角色(如node-role.kubernetes.io/master="")可能会导致 pod 无法调度。因此,将默认节点选择器设置为特定节点角色时要小心。您还可以使用项目节点选择器来避免集群范围节点选择器键冲突。

编辑

Scheduler对象:$ oc edit scheduler cluster使用适当的节点选择器添加

defaultNodeSelector字段:apiVersion: config.openshift.io/v1 kind: Scheduler metadata: name: cluster ... spec: defaultNodeSelector: topology.kubernetes.io/region=us-east-11 ...- 1

- 默认情况下,此节点选择器示例将容器集部署到

us-east-1区域的节点。

- 保存文件以使改变生效。

现在,您可以将基础架构资源移到新标记的 infra 节点。

4.4.3. 为基础架构机器创建机器配置池

如果需要基础架构机器具有专用配置,则必须创建一个 infra 池。

流程

向您要分配为带有特定标签的 infra 节点的节点添加标签:

$ oc label node <node_name> <label>$ oc label node ci-ln-n8mqwr2-f76d1-xscn2-worker-c-6fmtx node-role.kubernetes.io/infra=创建包含 worker 角色和自定义角色作为机器配置选择器的机器配置池:

$ cat infra.mcp.yaml输出示例

apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfigPool metadata: name: infra spec: machineConfigSelector: matchExpressions: - {key: machineconfiguration.openshift.io/role, operator: In, values: [worker,infra]}1 nodeSelector: matchLabels: node-role.kubernetes.io/infra: ""2 注意自定义机器配置池从 worker 池中继承机器配置。自定义池使用任何针对 worker 池的机器配置,但增加了部署仅针对自定义池的更改的功能。由于自定义池从 worker 池中继承资源,对 worker 池的任何更改也会影响自定义池。

具有 YAML 文件后,您可以创建机器配置池:

$ oc create -f infra.mcp.yaml检查机器配置,以确保基础架构配置成功:

$ oc get machineconfig输出示例

NAME GENERATEDBYCONTROLLER IGNITIONVERSION CREATED 00-master 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 31d 00-worker 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 31d 01-master-container-runtime 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 31d 01-master-kubelet 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 31d 01-worker-container-runtime 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 31d 01-worker-kubelet 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 31d 99-master-1ae2a1e0-a115-11e9-8f14-005056899d54-registries 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 31d 99-master-ssh 3.2.0 31d 99-worker-1ae64748-a115-11e9-8f14-005056899d54-registries 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 31d 99-worker-ssh 3.2.0 31d rendered-infra-4e48906dca84ee702959c71a53ee80e7 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 23m rendered-master-072d4b2da7f88162636902b074e9e28e 5b6fb8349a29735e48446d435962dec4547d3090 3.2.0 31d rendered-master-3e88ec72aed3886dec061df60d16d1af 02c07496ba0417b3e12b78fb32baf6293d314f79 3.2.0 31d rendered-master-419bee7de96134963a15fdf9dd473b25 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 17d rendered-master-53f5c91c7661708adce18739cc0f40fb 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 13d rendered-master-a6a357ec18e5bce7f5ac426fc7c5ffcd 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 7d3h rendered-master-dc7f874ec77fc4b969674204332da037 5b6fb8349a29735e48446d435962dec4547d3090 3.2.0 31d rendered-worker-1a75960c52ad18ff5dfa6674eb7e533d 5b6fb8349a29735e48446d435962dec4547d3090 3.2.0 31d rendered-worker-2640531be11ba43c61d72e82dc634ce6 5b6fb8349a29735e48446d435962dec4547d3090 3.2.0 31d rendered-worker-4e48906dca84ee702959c71a53ee80e7 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 7d3h rendered-worker-4f110718fe88e5f349987854a1147755 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 17d rendered-worker-afc758e194d6188677eb837842d3b379 02c07496ba0417b3e12b78fb32baf6293d314f79 3.2.0 31d rendered-worker-daa08cc1e8f5fcdeba24de60cd955cc3 365c1cfd14de5b0e3b85e0fc815b0060f36ab955 3.2.0 13d您应该会看到一个新的机器配置,带有

rendered-infra-*前缀。可选:要部署对自定义池的更改,请创建一个机器配置,该配置使用自定义池名称作为标签,如本例中的

infra。请注意,这不是必须的,在此包括仅用于指示目的。这样,您可以只应用特定于 infra 节点的任何自定义配置。注意创建新机器配置池后,MCO 会为该池生成一个新的呈现配置,以及该池重启的关联节点以应用新配置。

创建机器配置:

$ cat infra.mc.yaml输出示例

apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: name: 51-infra labels: machineconfiguration.openshift.io/role: infra1 spec: config: ignition: version: 3.2.0 storage: files: - path: /etc/infratest mode: 0644 contents: source: data:,infra- 1

- 将您添加的标签作为

nodeSelector添加到节点。

将机器配置应用到 infra-labeled 节点:

$ oc create -f infra.mc.yaml

确认您的新机器配置池可用:

$ oc get mcp输出示例

NAME CONFIG UPDATED UPDATING DEGRADED MACHINECOUNT READYMACHINECOUNT UPDATEDMACHINECOUNT DEGRADEDMACHINECOUNT AGE infra rendered-infra-60e35c2e99f42d976e084fa94da4d0fc True False False 1 1 1 0 4m20s master rendered-master-9360fdb895d4c131c7c4bebbae099c90 True False False 3 3 3 0 91m worker rendered-worker-60e35c2e99f42d976e084fa94da4d0fc True False False 2 2 2 0 91m在本例中,worker 节点被改为一个 infra 节点。

4.5. 为基础架构节点分配机器设置资源

在创建了基础架构机器集后,worker 和 infra 角色将应用到新的 infra 节点。具有 infra 角色的节点不会计入运行环境所需的订阅总数中,即使也应用了 worker 角色。

但是,当为 infra 节点分配 worker 角色时,用户工作负载可能会意外地分配给 infra 节点。要避免这种情况,您可以将污点应用到 infra 节点,并为您要控制的 pod 应用容限。

4.5.1. 使用污点和容限绑定基础架构节点工作负载

如果您有一个分配了 infra 和 worker 角色的 infra 节点,您必须配置该节点,以便不为其分配用户工作负载。

建议您保留为 infra 节点创建的双 infra,worker 标签,并使用污点和容限来管理用户工作负载调度到的节点。如果从节点中删除 worker 标签,您必须创建一个自定义池来管理它。没有自定义池的 MCO 不能识别具有 master 或 worker 以外的标签的节点。如果不存在选择自定义标签的自定义池,维护 worker 标签可允许默认 worker 机器配置池管理节点。infra 标签与集群通信,它不计算订阅总数。

先决条件

-

在 OpenShift Container Platform 集群中配置额外的

MachineSet对象。

流程

向 infra 节点添加污点以防止在其上调度用户工作负载:

确定节点是否具有污点:

$ oc describe nodes <node_name>输出示例

oc describe node ci-ln-iyhx092-f76d1-nvdfm-worker-b-wln2l Name: ci-ln-iyhx092-f76d1-nvdfm-worker-b-wln2l Roles: worker ... Taints: node-role.kubernetes.io/infra:NoSchedule ...本例显示节点具有污点。您可以在下一步中继续向 pod 添加容限。

如果您还没有配置污点以防止在其上调度用户工作负载:

$ oc adm taint nodes <node_name> <key>:<effect>例如:

$ oc adm taint nodes node1 node-role.kubernetes.io/infra:NoSchedule提示您还可以应用以下 YAML 来添加污点:

kind: Node apiVersion: v1 metadata: name: <node_name> labels: ... spec: taints: - key: node-role.kubernetes.io/infra effect: NoSchedule ...本例在

node1上放置一个键为node-role.kubernetes.io/infra的污点,污点是NoSchedule。具有NoSchedule effect的节点仅调度容许该污点的 pod,但允许现有 pod 继续调度到该节点上。注意如果使用 descheduler,则违反了节点污点的 pod 可能会从集群驱除。

为要在 infra 节点上调度的 pod 配置添加容限,如路由器、registry 和监控工作负载。在

Pod对象规格中添加以下代码:tolerations: - effect: NoSchedule1 key: node-role.kubernetes.io/infra2 operator: Exists3 此容忍度与

oc adm taint命令创建的污点匹配。具有此容忍度的 pod 可以调度到 infra 节点上。注意并不总是能够将通过 OLM 安装的 Operator 的 Pod 移到 infra 节点。移动 Operator Pod 的能力取决于每个 Operator 的配置。

- 使用调度程序将 pod 调度到 infra 节点。详情请参阅控制节点上的 pod 放置的文档。

4.6. 将资源移到基础架构机器集

默认情况下,您的集群中已部署了某些基础架构资源。您可将它们移至您创建的基础架构机器集。

4.6.1. 移动路由器

您可以将路由器 pod 部署到不同的机器集中。默认情况下,pod 部署到 worker 节点。

先决条件

- 在 OpenShift Container Platform 集群中配置额外的机器集。

流程

查看路由器 Operator 的

IngressController自定义资源:$ oc get ingresscontroller default -n openshift-ingress-operator -o yaml命令输出类似于以下文本:

apiVersion: operator.openshift.io/v1 kind: IngressController metadata: creationTimestamp: 2019-04-18T12:35:39Z finalizers: - ingresscontroller.operator.openshift.io/finalizer-ingresscontroller generation: 1 name: default namespace: openshift-ingress-operator resourceVersion: "11341" selfLink: /apis/operator.openshift.io/v1/namespaces/openshift-ingress-operator/ingresscontrollers/default uid: 79509e05-61d6-11e9-bc55-02ce4781844a spec: {} status: availableReplicas: 2 conditions: - lastTransitionTime: 2019-04-18T12:36:15Z status: "True" type: Available domain: apps.<cluster>.example.com endpointPublishingStrategy: type: LoadBalancerService selector: ingresscontroller.operator.openshift.io/deployment-ingresscontroller=default编辑

ingresscontroller资源,并更改nodeSelector以使用infra标签:$ oc edit ingresscontroller default -n openshift-ingress-operatorspec: nodePlacement: nodeSelector:1 matchLabels: node-role.kubernetes.io/infra: "" tolerations: - effect: NoSchedule key: node-role.kubernetes.io/infra value: reserved - effect: NoExecute key: node-role.kubernetes.io/infra value: reserved- 1

- 添加

nodeSelector参数,并设为适用于您想要移动的组件的值。您可以根据为节点指定的值,按所示格式使用nodeSelector或使用<key>: <value>对。如果您在 infrasructure 节点中添加了污点,还要添加匹配的容限。

确认路由器 Pod 在

infra节点上运行。查看路由器 Pod 列表,并记下正在运行的 Pod 的节点名称:

$ oc get pod -n openshift-ingress -o wide输出示例

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES router-default-86798b4b5d-bdlvd 1/1 Running 0 28s 10.130.2.4 ip-10-0-217-226.ec2.internal <none> <none> router-default-955d875f4-255g8 0/1 Terminating 0 19h 10.129.2.4 ip-10-0-148-172.ec2.internal <none> <none>在本例中,正在运行的 Pod 位于

ip-10-0-217-226.ec2.internal节点上。查看正在运行的 Pod 的节点状态:

$ oc get node <node_name>1 - 1

- 指定从 Pod 列表获得的

<node_name>。

输出示例

NAME STATUS ROLES AGE VERSION ip-10-0-217-226.ec2.internal Ready infra,worker 17h v1.21.0由于角色列表包含

infra,因此 Pod 在正确的节点上运行。

4.6.2. 移动默认 registry

您需要配置 registry Operator,以便将其 Pod 部署到其他节点。

先决条件

- 在 OpenShift Container Platform 集群中配置额外的机器集。

流程

查看

config/instance对象:$ oc get configs.imageregistry.operator.openshift.io/cluster -o yaml输出示例

apiVersion: imageregistry.operator.openshift.io/v1 kind: Config metadata: creationTimestamp: 2019-02-05T13:52:05Z finalizers: - imageregistry.operator.openshift.io/finalizer generation: 1 name: cluster resourceVersion: "56174" selfLink: /apis/imageregistry.operator.openshift.io/v1/configs/cluster uid: 36fd3724-294d-11e9-a524-12ffeee2931b spec: httpSecret: d9a012ccd117b1e6616ceccb2c3bb66a5fed1b5e481623 logging: 2 managementState: Managed proxy: {} replicas: 1 requests: read: {} write: {} storage: s3: bucket: image-registry-us-east-1-c92e88cad85b48ec8b312344dff03c82-392c region: us-east-1 status: ...编辑

config/instance对象:$ oc edit configs.imageregistry.operator.openshift.io/clusterspec: affinity: podAntiAffinity: preferredDuringSchedulingIgnoredDuringExecution: - podAffinityTerm: namespaces: - openshift-image-registry topologyKey: kubernetes.io/hostname weight: 100 logLevel: Normal managementState: Managed nodeSelector:1 node-role.kubernetes.io/infra: "" tolerations: - effect: NoSchedule key: node-role.kubernetes.io/infra value: reserved - effect: NoExecute key: node-role.kubernetes.io/infra value: reserved- 1

- 添加

nodeSelector参数,并设为适用于您想要移动的组件的值。您可以根据为节点指定的值,按所示格式使用nodeSelector或使用<key>: <value>对。如果您在 infrasructure 节点中添加了污点,还要添加匹配的容限。

验证 registry pod 已移至基础架构节点。

运行以下命令,以识别 registry pod 所在的节点:

$ oc get pods -o wide -n openshift-image-registry确认节点具有您指定的标签:

$ oc describe node <node_name>查看命令输出,并确认

node-role.kubernetes.io/infra列在LABELS列表中。

4.6.3. 移动监控解决方案

监控堆栈包含多个组件,包括 Prometheus、Grafana 和 Alertmanager。Cluster Monitoring Operator 管理此堆栈。要将监控堆栈重新部署到基础架构节点,您可以创建并应用自定义配置映射。

流程

编辑

cluster-monitoring-config配置映射,并更改nodeSelector以使用infra标签:$ oc edit configmap cluster-monitoring-config -n openshift-monitoringapiVersion: v1 kind: ConfigMap metadata: name: cluster-monitoring-config namespace: openshift-monitoring data: config.yaml: |+ alertmanagerMain: nodeSelector:1 node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute prometheusK8s: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute prometheusOperator: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute grafana: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute k8sPrometheusAdapter: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute kubeStateMetrics: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute telemeterClient: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute openshiftStateMetrics: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute thanosQuerier: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute- 1

- 添加

nodeSelector参数,并设为适用于您想要移动的组件的值。您可以根据为节点指定的值,按所示格式使用nodeSelector或使用<key>: <value>对。如果您在 infrasructure 节点中添加了污点,还要添加匹配的容限。

观察监控 pod 移至新机器:

$ watch 'oc get pod -n openshift-monitoring -o wide'如果组件没有移到

infra节点,请删除带有这个组件的 pod:$ oc delete pod -n openshift-monitoring <pod>已删除 pod 的组件在

infra节点上重新创建。

4.6.4. 移动 OpenShift Logging 资源

您可以配置 Cluster Logging Operator,将 OpenShift Logging 组件(如 Elasticsearch 和 Kibana)的 pod 部署到不同的节点上。您无法将 Cluster Logging Operator Pod 从其安装位置移走。

例如,您可以因为 CPU、内存和磁盘要求较高而将 Elasticsearch Pod 移到一个单独的节点上。

先决条件

- 必须安装 OpenShift Logging 和 Elasticsearch。默认情况下没有安装这些功能。

流程

编辑

openshift-logging项目中的ClusterLogging自定义资源(CR):$ oc edit ClusterLogging instanceapiVersion: logging.openshift.io/v1 kind: ClusterLogging ... spec: collection: logs: fluentd: resources: null type: fluentd logStore: elasticsearch: nodeCount: 3 nodeSelector:1 node-role.kubernetes.io/infra: '' tolerations: - effect: NoSchedule key: node-role.kubernetes.io/infra value: reserved - effect: NoExecute key: node-role.kubernetes.io/infra value: reserved redundancyPolicy: SingleRedundancy resources: limits: cpu: 500m memory: 16Gi requests: cpu: 500m memory: 16Gi storage: {} type: elasticsearch managementState: Managed visualization: kibana: nodeSelector:2 node-role.kubernetes.io/infra: '' tolerations: - effect: NoSchedule key: node-role.kubernetes.io/infra value: reserved - effect: NoExecute key: node-role.kubernetes.io/infra value: reserved proxy: resources: null replicas: 1 resources: null type: kibana ...

验证

要验证组件是否已移动,您可以使用 oc get pod -o wide 命令。

例如:

您需要移动来自

ip-10-0-147-79.us-east-2.compute.internal节点上的 Kibana pod:$ oc get pod kibana-5b8bdf44f9-ccpq9 -o wide输出示例

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES kibana-5b8bdf44f9-ccpq9 2/2 Running 0 27s 10.129.2.18 ip-10-0-147-79.us-east-2.compute.internal <none> <none>您需要将 Kibana pod 移到

ip-10-0-139-48.us-east-2.compute.internal节点,该节点是一个专用的基础架构节点:$ oc get nodes输出示例

NAME STATUS ROLES AGE VERSION ip-10-0-133-216.us-east-2.compute.internal Ready master 60m v1.21.0 ip-10-0-139-146.us-east-2.compute.internal Ready master 60m v1.21.0 ip-10-0-139-192.us-east-2.compute.internal Ready worker 51m v1.21.0 ip-10-0-139-241.us-east-2.compute.internal Ready worker 51m v1.21.0 ip-10-0-147-79.us-east-2.compute.internal Ready worker 51m v1.21.0 ip-10-0-152-241.us-east-2.compute.internal Ready master 60m v1.21.0 ip-10-0-139-48.us-east-2.compute.internal Ready infra 51m v1.21.0请注意,该节点具有

node-role.kubernetes.io/infra: "label:$ oc get node ip-10-0-139-48.us-east-2.compute.internal -o yaml输出示例

kind: Node apiVersion: v1 metadata: name: ip-10-0-139-48.us-east-2.compute.internal selfLink: /api/v1/nodes/ip-10-0-139-48.us-east-2.compute.internal uid: 62038aa9-661f-41d7-ba93-b5f1b6ef8751 resourceVersion: '39083' creationTimestamp: '2020-04-13T19:07:55Z' labels: node-role.kubernetes.io/infra: '' ...要移动 Kibana pod,编辑

ClusterLoggingCR 以添加节点选择器:apiVersion: logging.openshift.io/v1 kind: ClusterLogging ... spec: ... visualization: kibana: nodeSelector:1 node-role.kubernetes.io/infra: '' proxy: resources: null replicas: 1 resources: null type: kibana- 1

- 添加节点选择器以匹配节点规格中的 label。

保存 CR 后,当前 Kibana Pod 将被终止,新的 Pod 会被部署:

$ oc get pods输出示例

NAME READY STATUS RESTARTS AGE cluster-logging-operator-84d98649c4-zb9g7 1/1 Running 0 29m elasticsearch-cdm-hwv01pf7-1-56588f554f-kpmlg 2/2 Running 0 28m elasticsearch-cdm-hwv01pf7-2-84c877d75d-75wqj 2/2 Running 0 28m elasticsearch-cdm-hwv01pf7-3-f5d95b87b-4nx78 2/2 Running 0 28m fluentd-42dzz 1/1 Running 0 28m fluentd-d74rq 1/1 Running 0 28m fluentd-m5vr9 1/1 Running 0 28m fluentd-nkxl7 1/1 Running 0 28m fluentd-pdvqb 1/1 Running 0 28m fluentd-tflh6 1/1 Running 0 28m kibana-5b8bdf44f9-ccpq9 2/2 Terminating 0 4m11s kibana-7d85dcffc8-bfpfp 2/2 Running 0 33s新 pod 位于

ip-10-0-139-48.us-east-2.compute.internal节点上 :$ oc get pod kibana-7d85dcffc8-bfpfp -o wide输出示例

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES kibana-7d85dcffc8-bfpfp 2/2 Running 0 43s 10.131.0.22 ip-10-0-139-48.us-east-2.compute.internal <none> <none>片刻后,原始 Kibana Pod 将被删除。

$ oc get pods输出示例

NAME READY STATUS RESTARTS AGE cluster-logging-operator-84d98649c4-zb9g7 1/1 Running 0 30m elasticsearch-cdm-hwv01pf7-1-56588f554f-kpmlg 2/2 Running 0 29m elasticsearch-cdm-hwv01pf7-2-84c877d75d-75wqj 2/2 Running 0 29m elasticsearch-cdm-hwv01pf7-3-f5d95b87b-4nx78 2/2 Running 0 29m fluentd-42dzz 1/1 Running 0 29m fluentd-d74rq 1/1 Running 0 29m fluentd-m5vr9 1/1 Running 0 29m fluentd-nkxl7 1/1 Running 0 29m fluentd-pdvqb 1/1 Running 0 29m fluentd-tflh6 1/1 Running 0 29m kibana-7d85dcffc8-bfpfp 2/2 Running 0 62s

4.7. 关于集群自动扩展

集群自动扩展会调整 OpenShift Container Platform 集群的大小,以满足其当前的部署需求。它使用 Kubernetes 样式的声明性参数来提供基础架构管理,而且这种管理不依赖于特定云提供商的对象。集群自动控制会在集群范围内有效,不与特定的命名空间相关联。

当由于资源不足而无法在任何当前 worker 节点上调度 pod 时,或者在需要另一个节点来满足部署需求时,集群自动扩展会增加集群的大小。集群自动扩展不会将集群资源增加到超过您指定的限制。

集群自动扩展会计算集群中所有节点上的内存、CPU 和 GPU,即使它不管理 control plane 节点。这些值不是单计算机导向型。它们是整个集群中所有资源的聚合。例如,如果您设置最大内存资源限制,集群自动扩展在计算当前内存用量时包括集群中的所有节点。然后,该计算用于确定集群自动扩展是否具有添加更多 worker 资源的容量。

确保您所创建的 ClusterAutoscaler 资源定义中的 maxNodesTotal 值足够大,足以满足计算集群中可能的机器总数。此值必须包含 control plane 机器的数量以及可扩展至的机器数量。

每隔 10 秒,集群自动扩展会检查集群中不需要哪些节点,并移除它们。如果满足以下条件,集群自动扩展会考虑要删除的节点:

- 节点上运行的所有 pod 的 CPU 和内存请求总和小于节点上分配资源的 50%。

- 集群自动扩展可以将节点上运行的所有 pod 移到其他节点。

- 集群自动扩展没有缩减禁用注解。

如果节点上存在以下类型的 pod,集群自动扩展不会删除该节点:

- 具有限制性 pod 中断预算(PDB)的 Pod。

- 默认不在节点上运行的 Kube 系统 Pod。

- 没有 PDB 或 PDB 限制性太强的 Kube 系统 pod。

- 不受控制器对象支持的 Pod,如部署、副本集或有状态集。

- 具有本地存储的 Pod。

- 因为缺乏资源、节点选择器或关联性不兼容或有匹配的反关联性等原因而无法移至其他位置的 Pod。

-

具有

"cluster-autoscaler.kubernetes.io/safe-to-evict": "false"注解的 Pod,除非同时也具有"cluster-autoscaler.kubernetes.io/safe-to-evict": "true”注解。

例如,您可以将最大 CPU 限值设置为 64 个内核,并将集群自动扩展配置为每个创建具有 8 个内核的机器。如果您的集群从 30 个内核开始,集群自动扩展可最多添加具有 32 个内核的 4 个节点,共 62 个。

如果配置集群自动扩展,则需要额外的使用限制:

- 不要直接修改位于自动扩展节点组中的节点。同一节点组中的所有节点具有相同的容量和标签,并且运行相同的系统 Pod。

- 指定适合您的 Pod 的请求。

- 如果需要防止 Pod 被过快删除,请配置适当的 PDB。

- 确认您的云提供商配额足够大,能够支持您配置的最大节点池。

- 不要运行其他节点组自动扩展器,特别是云提供商提供的自动扩展器。

pod 横向自动扩展(HPA)和集群自动扩展以不同的方式修改集群资源。HPA 根据当前的 CPU 负载更改部署或副本集的副本数。如果负载增加,HPA 会创建新的副本,不论集群可用的资源量如何。如果没有足够的资源,集群自动扩展会添加资源,以便 HPA 创建的 pod 可以运行。如果负载减少,HPA 会停止一些副本。如果此操作导致某些节点利用率低下或完全为空,集群自动扩展会删除不必要的节点。

集群自动扩展会考虑 pod 优先级。如果集群没有足够的资源,则“Pod 优先级和抢占”功能可根据优先级调度 Pod,但集群自动扩展会确保集群具有运行所有 Pod 需要的资源。为满足这两个功能,集群自动扩展包含一个优先级截止函数。您可以使用此截止函数来调度“尽力而为”的 Pod,它们不会使集群自动扩展增加资源,而是仅在有可用备用资源时运行。

优先级低于截止值的 Pod 不会导致集群扩展或阻止集群缩减。系统不会添加新节点来运行 Pod,并且可能会删除运行这些 Pod 的节点来释放资源。

4.7.1. ClusterAutoscaler 资源定义

此 ClusterAutoscaler 资源定义显示了集群自动扩展的参数和示例值。

apiVersion: "autoscaling.openshift.io/v1"

kind: "ClusterAutoscaler"

metadata:

name: "default"

spec:

podPriorityThreshold: -10

resourceLimits:

maxNodesTotal: 24

cores:

min: 8

max: 128

memory:

min: 4

max: 256

gpus:

- type: nvidia.com/gpu

min: 0

max: 16

- type: amd.com/gpu

min: 0

max: 4

scaleDown:

enabled: true

delayAfterAdd: 10m

delayAfterDelete: 5m

delayAfterFailure: 30s

unneededTime: 5m - 1

- 指定 Pod 必须超过哪一优先级才能让机器自动扩展部署更多节点。输入一个 32 位整数值。

podPriorityThreshold值将与您分配给每个 Pod 的PriorityClass值进行比较。 - 2

- 指定要部署的最大节点数。这个值是集群中部署的机器总数,而不仅仅是自动扩展器控制的机器。确保这个值足够大,足以满足所有 control plane 和计算机器以及您在

MachineAutoscaler资源中指定的副本总数。 - 3

- 指定在集群中部署的最小内核数。

- 4

- 指定集群中要部署的最大内核数。

- 5

- 指定集群中最小内存量(以 GiB 为单位)。

- 6

- 指定集群中的最大内存量(以 GiB 为单位)。

- 7

- (可选)指定要部署的 GPU 节点的类型。只有

nvidia.com/gpu和amd.com/gpu是有效的类型。 - 8

- 指定在集群中部署的最小 GPU 数。

- 9

- 指定集群中要部署的最大 GPU 数量。

- 10

- 11

- 指定集群自动扩展是否可以删除不必要的节点。

- 12

- (可选)指定在最近添加节点之后要等待多久才能删除节点。如果不指定值,则使用默认值

10m。 - 13

- 指定在最近删除节点之后要等待多久才能删除节点。如果不指定值,则使用默认值

10s。 - 14

- 指定在发生缩减失败之后要等待多久才能删除节点。如果不指定值,则使用默认值

3m。 - 15

- 指定要经过多长时间之后,不需要的节点才符合删除条件。如果不指定值,则使用默认值

10m。

执行扩展操作时,集群自动扩展会保持在 ClusterAutoscaler 资源定义中设置的范围,如要部署的最小和最大内核数,或集群中的内存量。但是,集群自动扩展无法将集群中的当前值修正为在这些范围内。

最小和最大 CPU、内存和 GPU 值是通过计算集群中所有节点上的这些资源来确定,即使集群自动扩展无法管理该节点。例如,control plane 节点在集群的总内存中考虑,即使集群自动扩展不管理 control plane 节点。

4.7.2. 部署集群自动扩展

要部署集群自动扩展,请创建一个 ClusterAutoscaler 资源实例。

流程

-

为

ClusterAutoscaler资源创建一个 YAML 文件,其中包含自定义的资源定义。 在集群中创建资源:

$ oc create -f <filename>.yaml1 - 1

<filename>是您自定义的资源文件的名称。

4.8. 关于机器自动扩展

机器自动扩展会调整您在 OpenShift Container Platform 集群中部署的机器集中的 Machine 数量。您可以扩展默认 worker 机器集,以及您创建的其他机器集。当集群没有足够资源来支持更多部署时,机器自动扩展会增加 Machine。对 MachineAutoscaler 资源中的值(如最小或最大实例数量)的任何更改都会立即应用到目标机器设置中。

您必须部署机器自动扩展才能使用集群自动扩展功能来扩展机器。集群自动扩展使用机器自动扩展集上的注解来确定可扩展的资源。如果您在没有定义机器自动扩展的情况下定义集群自动扩展,集群自动扩展永远不会扩展集群。

4.8.1. MachineAutoscaler 资源定义

此 MachineAutoscaler 资源定义显示了机器自动扩展器的参数和示例值。

apiVersion: "autoscaling.openshift.io/v1beta1"

kind: "MachineAutoscaler"

metadata:

name: "worker-us-east-1a"

namespace: "openshift-machine-api"

spec:

minReplicas: 1

maxReplicas: 12

scaleTargetRef:

apiVersion: machine.openshift.io/v1beta1

kind: MachineSet

name: worker-us-east-1a - 1

- 指定机器自动扩展名称。为了更容易识别此机器自动扩展会扩展哪些机器集,请指定或注明要扩展的机器集的名称。机器集名称采用以下形式:

<clusterid>-<machineset>-<region>。 - 2

- 指定在机器自动扩展启动集群扩展后必须保留在指定区域中的指定类型的最小机器数量。如果在 AWS、GCP、Azure、RHOSP 或 vSphere 中运行,则此值可设为

0。对于其他供应商,请不要将此值设置为0。对于用于特殊工作负载的高价或有限使用硬件,或者扩展具有额外大型机器的机器集,您可以将此值设置为

0来节约成本。如果机器没有使用,集群自动扩展会将机器集缩减为零。重要对于安装程序置备的基础架构,请不要将 OpenShift Container Platform 安装过程中创建的三台计算机器集的

spec.minReplicas值设置为0。 - 3

- 指定集群自动扩展初始化集群扩展后可在指定类型区域中部署的指定类型的最大机器数量。确保

ClusterAutoscaler资源定义的maxNodesTotal值足够大,以便机器自动扩展器可以部署这个数量的机器。 - 4

- 在本小节中,提供用于描述要扩展的现有机器集的值。

- 5

kind参数值始终为MachineSet。- 6

name值必须与现有机器集的名称匹配,如metadata.name参数值所示。

4.8.2. 部署机器自动扩展

要部署机器自动扩展,请创建一个 MachineAutoscaler 资源实例。

流程

-

为

MachineAutoscaler资源创建一个 YAML 文件,其中包含自定义的资源定义。 在集群中创建资源:

$ oc create -f <filename>.yaml1 - 1

<filename>是您自定义的资源文件的名称。

4.9. 使用 FeatureGate 启用技术预览功能

您可以通过编辑 FeatureGate 自定义资源(CR)为集群中的所有节点开启当前技术预览功能的子集。

4.9.1. 了解功能门

您可以使用 FeatureGate 自定义资源(CR)在集群中启用特定的功能集。功能集是 OpenShift Container Platform 功能的集合,默认情况下不启用。

您可以使用 FeatureGate CR 激活以下任何功能集:

TechPreviewNoUpgrade.这个功能集是当前技术预览功能的子集。此功能集允许您在测试集群中启用这些技术预览功能,您可以在测试集群中完全测试它们,同时保留生产集群中禁用的功能。启用此功能集无法撤消并阻止次版本更新。不建议在生产环境集群中使用此功能集。警告在集群中启用

TechPreviewNoUpgrade功能集无法撤消,并会阻止次版本更新。您不应该在生产环境集群中启用此功能。此功能集启用了以下技术预览功能:

- Azure Disk CSI Driver Operator。使用 Microsoft Azure Disk Storage 的 Container Storage Interface(CSI)驱动程序启用持久性卷(PV)置备。

- VMware vSphere CSI Driver Operator。使用 Virtual Machine Disk(VMDK)卷的 Container Storage Interface(CSI)VMware vSphere 驱动程序启用持久性卷(PV)。

CSI 自动迁移。为支持的树内卷插件启用自动迁移,并将其对应的 Container Storage Interface(CSI)驱动程序。作为技术预览提供:

- Amazon Web Services(AWS)Elastic Block Storage(EBS)

- OpenStack Cinder

4.9.2. 使用 Web 控制台启用功能集

您可以通过编辑 FeatureGate 自定义资源(CR)来使用 OpenShift Container Platform Web 控制台为集群中的所有节点启用功能集。

流程

启用功能集:

- 在 OpenShift Container Platform web 控制台中,切换到 Administration → Custom Resource Definitions 页面。

- 在 Custom Resource Definitions 页面中,点击 FeatureGate。

- 在 Custom Resource Definition Details 页面中,点 Instances 选项卡。

- 点 集群 功能门,然后点 YAML 选项卡。

编辑集群实例以添加特定的功能集:

警告在集群中启用

TechPreviewNoUpgrade功能集无法撤消,并会阻止次版本更新。您不应该在生产环境集群中启用此功能。功能门自定义资源示例

apiVersion: config.openshift.io/v1 kind: FeatureGate metadata: name: cluster1 .... spec: featureSet: TechPreviewNoUpgrade2 保存更改后,会创建新的机器配置,然后更新机器配置池,并在应用更改时在每个节点上调度。

验证

您可以在节点返回就绪状态后查看节点上的 kubelet.conf 文件来验证是否启用了功能门。

- 从 Web 控制台中的 Administrator 视角,进入到 Compute → Nodes。

- 选择一个节点。

- 在 Node 详情页面中,点 Terminal。

在终端窗口中,将根目录改为

/host:sh-4.2# chroot /host查看

kubelet.conf文件:sh-4.2# cat /etc/kubernetes/kubelet.conf输出示例

... featureGates: InsightsOperatorPullingSCA: true, LegacyNodeRoleBehavior: false ...在集群中启用列为

true的功能。注意列出的功能因 OpenShift Container Platform 版本的不同而有所不同。

4.9.3. 使用 CLI 启用功能集

您可以通过编辑 FeatureGate 自定义资源(CR)来使用 OpenShift CLI(oc)为集群中的所有节点启用功能集。

先决条件

-

已安装 OpenShift CLI(

oc)。

流程

启用功能集:

编辑名为

cluster的FeatureGateCR:$ oc edit featuregate cluster警告在集群中启用

TechPreviewNoUpgrade功能集无法撤消,并会阻止次版本更新。您不应该在生产环境集群中启用此功能。FeatureGate 自定义资源示例

apiVersion: config.openshift.io/v1 kind: FeatureGate metadata: name: cluster1 spec: featureSet: TechPreviewNoUpgrade2 保存更改后,会创建新的机器配置,然后更新机器配置池,并在应用更改时在每个节点上调度。

验证

您可以在节点返回就绪状态后查看节点上的 kubelet.conf 文件来验证是否启用了功能门。

- 从 Web 控制台中的 Administrator 视角,进入到 Compute → Nodes。

- 选择一个节点。

- 在 Node 详情页面中,点 Terminal。

在终端窗口中,将根目录改为

/host:sh-4.2# chroot /host查看

kubelet.conf文件:sh-4.2# cat /etc/kubernetes/kubelet.conf输出示例

... featureGates: InsightsOperatorPullingSCA: true, LegacyNodeRoleBehavior: false ...在集群中启用列为

true的功能。注意列出的功能因 OpenShift Container Platform 版本的不同而有所不同。

4.10. etcd 任务

备份 etcd、启用或禁用 etcd 加密或清除 etcd 数据。

4.10.1. 关于 etcd 加密

默认情况下,OpenShift Container Platform 不加密 etcd 数据。在集群中启用对 etcd 进行加密的功能可为数据的安全性提供额外的保护层。例如,如果 etcd 备份暴露给不应该获得这个数据的人员,它会帮助保护敏感数据。

启用 etcd 加密时,以下 OpenShift API 服务器和 Kubernetes API 服务器资源将被加密:

- Secrets

- 配置映射

- Routes

- OAuth 访问令牌

- OAuth 授权令牌

当您启用 etcd 加密时,会创建加密密钥。这些密钥会每周进行轮转。您必须具有这些密钥才能从 etcd 备份中恢复。

etcd 加密只加密值,而不加密键。资源类型、命名空间和对象名称是未加密的。

如果在备份过程中启用了 etcd 加密,static_kuberesources_<datetimestamp>.tar.gz 文件包含 etcd 快照的加密密钥。为安全起见,请将此文件与 etcd 快照分开存储。但是,需要这个文件才能从相应的 etcd 快照恢复以前的 etcd 状态。

4.10.2. 启用 etcd 加密

您可以启用 etcd 加密来加密集群中的敏感资源。

在初始加密过程完成前,不要备份 etcd 资源。如果加密过程还没有完成,则备份可能只被部分加密。

启用 etcd 加密后,可能会出现一些更改:

- etcd 加密可能会影响几个资源的内存消耗。

- 您可能会注意到对备份性能具有临时影响,因为领导必须提供备份服务。

- 磁盘 I/O 可能会影响接收备份状态的节点。

先决条件

-

使用具有

cluster-admin角色的用户访问集群。

流程

修改

APIServer对象:$ oc edit apiserver把

encryption项类型设置为aescbc:spec: encryption: type: aescbc1 - 1

aescbc类型表示 AES-CBC 使用 PKCS#7 padding 和 32 字节密钥来执行加密。

保存文件以使改变生效。

加密过程开始。根据集群的大小,这个过程可能需要 20 分钟或更长的时间才能完成。

验证 etcd 加密是否成功。

查看 OpenShift API 服务器的

Encrypted状态条件,以验证其资源是否已成功加密:$ oc get openshiftapiserver -o=jsonpath='{range .items[0].status.conditions[?(@.type=="Encrypted")]}{.reason}{"\n"}{.message}{"\n"}'在成功加密后输出显示

EncryptionCompleted:EncryptionCompleted All resources encrypted: routes.route.openshift.io如果输出显示

EncryptionInProgress,加密仍在进行中。等待几分钟后重试。查看 Kubernetes API 服务器的

Encrypted状态条件,以验证其资源是否已成功加密:$ oc get kubeapiserver -o=jsonpath='{range .items[0].status.conditions[?(@.type=="Encrypted")]}{.reason}{"\n"}{.message}{"\n"}'在成功加密后输出显示

EncryptionCompleted:EncryptionCompleted All resources encrypted: secrets, configmaps如果输出显示

EncryptionInProgress,加密仍在进行中。等待几分钟后重试。查看 OpenShift OAuth API 服务器的

Encrypted状态条件,以验证其资源是否已成功加密:$ oc get authentication.operator.openshift.io -o=jsonpath='{range .items[0].status.conditions[?(@.type=="Encrypted")]}{.reason}{"\n"}{.message}{"\n"}'在成功加密后输出显示

EncryptionCompleted:EncryptionCompleted All resources encrypted: oauthaccesstokens.oauth.openshift.io, oauthauthorizetokens.oauth.openshift.io如果输出显示

EncryptionInProgress,加密仍在进行中。等待几分钟后重试。

4.10.3. 禁用 etcd 加密

您可以在集群中禁用 etcd 数据的加密。

先决条件

-

使用具有

cluster-admin角色的用户访问集群。

流程

修改

APIServer对象:$ oc edit apiserver将

encryption字段类型设置为identity:spec: encryption: type: identity1 - 1

identity类型是默认值,意味着没有执行任何加密。

保存文件以使改变生效。

解密过程开始。根据集群的大小,这个过程可能需要 20 分钟或更长的时间才能完成。

验证 etcd 解密是否成功。

查看 OpenShift API 服务器的

Encrypted状态条件,以验证其资源是否已成功解密:$ oc get openshiftapiserver -o=jsonpath='{range .items[0].status.conditions[?(@.type=="Encrypted")]}{.reason}{"\n"}{.message}{"\n"}'在成功解密后输出显示

DecryptionCompleted:DecryptionCompleted Encryption mode set to identity and everything is decrypted如果输出显示

DecryptionInProgress,解密仍在进行中。等待几分钟后重试。查看 Kubernetes API 服务器的

Encrypted状态条件,以验证其资源是否已成功解密:$ oc get kubeapiserver -o=jsonpath='{range .items[0].status.conditions[?(@.type=="Encrypted")]}{.reason}{"\n"}{.message}{"\n"}'在成功解密后输出显示

DecryptionCompleted:DecryptionCompleted Encryption mode set to identity and everything is decrypted如果输出显示

DecryptionInProgress,解密仍在进行中。等待几分钟后重试。查看 OpenShift OAuth API 服务器的