监管

了解更多有关监管策略框架的信息,这有助于使用策略强化集群安全性。

摘要

第 1 章 风险和合规性

管理 Red Hat Advanced Cluster Management for Kubernetes 组件的安全性。使用定义的策略和流程监管集群,以识别并最大程度降低风险。使用策略来定义规则和设置控制。

先决条件:您必须为 Red Hat Advanced Cluster Management for Kubernetes 配置身份验证服务要求。如需更多信息,请参阅 访问控制。

查看以下主题以了解有关保护集群的更多信息:

1.1. 证书

在整个 Red Hat Advanced Cluster Management for Kubernetes 范围内会创建和使用各种证书。

您可以自带证书。为您的证书创建 Kubernetes TLS Secret。创建证书后,您可以替换由 Red Hat Advanced Cluster Management 安装程序创建的某些证书。

需要的访问权限: 集群管理员

在 Red Hat Advanced Cluster Management 中运行的服务所需的所有证书都是在 Red Hat Advanced Cluster Management 安装过程中创建的。证书由以下组件创建和管理:

- OpenShift Service Serving 证书

- Red Hat Advanced Cluster Management Webhook 控制器

- Kubernetes 证书 API

- OpenShift 默认入口

继续阅读以了解有关证书管理的更多信息:

Red Hat Advanced Cluster Management hub 集群证书

Red Hat Advanced Cluster Management 组件证书

Red Hat Advanced Cluster Management 管理的证书

注意 :用户负责证书轮转和更新。

1.1.1. Red Hat Advanced Cluster Management hub 集群证书

1.1.1.1. Observability 证书

安装 Red Hat Advanced Cluster Management 后,会创建可观察性证书并供可观察组件使用,以便在 hub 集群和受管集群间的网络流量上提供 mutual TLS。与可观察证书关联的 Kubernetes secret。

open-cluster-management-observability 命名空间包含以下证书:

-

Observability-server-ca-certs:获取 CA 证书来签署服务器端证书 -

Observability-client-ca-certs:获取 CA 证书来签署客户端的证书 -

Observability-server-certs:获取由observability-observatorium-api 部署使用的服务器证书 -

Observability-grafana-certs:获取observability-rbac-query-proxy部署使用的客户端证书

open-cluster-management-addon-observability 命名空间在受管集群中包含以下证书:

-

Observability-managed-cluster-certs:与 hub 服务器中的observability-server-ca-certs相同的服务器 CA 证书 -

observability-controller-open-cluster-management.io-observability-signer-client-cert:由被metrics-collector-deployment使用的客户证书

CA 证书的有效期为五年,其他证书的有效期为一年。所有可观察证书会在过期后自动刷新。

查看以下列表以了解证书自动更新时的影响:

- 当剩余的有效时间不超过 73 天时,非 CA 证书将自动续订。续订证书后,相关部署中的 Pod 会自动重启以使用更新的证书。

- 当剩余有效时间不超过一年时,CA 证书会被自动续订。证书被续订后,旧的 CA 不会被删除,而是与更新的 CA 共存。相关部署同时使用旧和更新的证书,并继续工作。旧的 CA 证书在过期时会被删除。

- 当证书被续订时,hub 集群和受管集群之间的流量不会中断。

1.1.1.2. 使用您自己的 (BYO) 可观察证书认证机构 (CA) 证书

如果您不想使用 Red Hat Advanced Cluster Management 生成的默认可观察性 CA 证书,您可以在启用可观察性前选择使用 BYO observability CA 证书。

1.1.1.2.1. 用于生成 CA 证书的 OpenSSL 命令

Observability 需要两个 CA 证书;一个用于服务器端,另一个用于客户端。

使用以下命令生成您的 CA RSA 私钥:

openssl genrsa -out serverCAKey.pem 2048 openssl genrsa -out clientCAKey.pem 2048使用私钥生成自签名 CA 证书。运行以下命令:

openssl req -x509 -sha256 -new -nodes -key serverCAKey.pem -days 1825 -out serverCACert.pem openssl req -x509 -sha256 -new -nodes -key clientCAKey.pem -days 1825 -out clientCACert.pem

1.1.1.2.2. 创建与 BYO observability CA 证书关联的 secret

完成以下步骤以创建 secret:

使用您的证书和私钥创建

observability-server-ca-certssecret。运行以下命令:oc -n open-cluster-management-observability create secret tls observability-server-ca-certs --cert ./serverCACert.pem --key ./serverCAKey.pem使用您的证书和私钥创建

observability-client-ca-certssecret。运行以下命令:oc -n open-cluster-management-observability create secret tls observability-client-ca-certs --cert ./clientCACert.pem --key ./clientCAKey.pem

1.1.1.2.3. 替换 alertmanager 路由的证书

如果您不想使用 OpenShift 默认入口证书,您可以通过更新 alertmanager 路由来替换 alertmanager 证书。完成以下步骤:

使用以下命令检查可观察证书:

openssl x509 -noout -text -in ./observability.crt-

将证书上的通用名称 (

CN) 更改为alertmanager。 -

使用 alertmanager 路由的主机名更改

csr.cnf配置文件中的 SAN。 在

open-cluster-management-observability命名空间中创建以下两个 secret。运行以下命令:oc -n open-cluster-management-observability create secret tls alertmanager-byo-ca --cert ./ca.crt --key ./ca.key oc -n open-cluster-management-observability create secret tls alertmanager-byo-cert --cert ./ingress.crt --key ./ingress.key

如需更多信息,请参阅 OpenSSL 命令以生成证书。如果要恢复 alertmanager 路由的默认自签名证书,请参阅为管理 ingress 恢复默认自签名证书以删除 open-cluster-management-observability 命名空间中的两个 secret。

1.1.2. Red Hat Advanced Cluster Management 组件证书

1.1.2.1. 列出 hub 集群受管证书

您可以查看在内部使用 OpenShift Service Serving 证书服务的 hub 集群受管证书列表。运行以下命令列出证书:

for ns in multicluster-engine open-cluster-management ; do echo "$ns:" ; oc get secret -n $ns -o custom-columns=Name:.metadata.name,Expiration:.metadata.annotations.service\\.beta\\.openshift\\.io/expiry | grep -v '<none>' ; echo ""; done注:如果启用了可观察性,则还需要额外的命名空间来创建证书。

1.1.2.2. 刷新 hub 集群受管证书

您可以通过运行在 列出 hub 集群受管证书部分介绍的 delete secret 命令来刷新 hub 集群受管证书。当您标识需要刷新的证书时,删除与该证书关联的 secret。例如,您可以运行以下命令删除 secret:

oc delete secret grc-0c925-grc-secrets -n open-cluster-management注:删除 secret 后会创建一个新 secret。但是,您必须手动重启使用该 secret 的 pod,以便它们能够开始使用新证书。

您可以刷新 OpenShift Container Platform 受管证书,它们是 Red Hat Advanced Cluster Management Webhook 使用的证书。

完成以下步骤以刷新 Red Hat Advanced Cluster Management Webhook 证书:

运行以下命令,删除与 OpenShift Container Platform 受管证书关联的 secret:

oc delete secret -n open-cluster-management ocm-webhook-secret注: 有些服务可能没有需要删除的 secret。

运行以下命令,重启与 OpenShift Container Platform 受管证书关联的服务:

oc delete po -n open-cluster-management ocm-webhook-679444669c-5cg76重要 :许多服务都有副本;每个服务都需要重启。

查看下表,了解包含证书的 pod 概述列表,以及是否需要在重启 pod 前删除 secret 的信息:

| 服务名称 | Namespace | pod 名称示例 | Secret 名称(如果适用) |

|---|---|---|---|

| channels-apps-open-cluster-management-webhook-svc | open-cluster-management | multicluster-operators-application-8c446664c-5lbfk | channels-apps-open-cluster-management-webhook-svc-ca |

| multicluster-operators-application-svc | open-cluster-management | multicluster-operators-application-8c446664c-5lbfk | multicluster-operators-application-svc-ca |

| cluster-manager-registration-webhook | open-cluster-management-hub | cluster-manager-registration-webhook-fb7b99c-d8wfc | registration-webhook-serving-cert |

| cluster-manager-work-webhook | open-cluster-management-hub | cluster-manager-work-webhook-89b8d7fc-f4pv8 | work-webhook-serving-cert |

1.1.3. Red Hat Advanced Cluster Management 管理的证书

1.1.3.1. 频道证书

CA 证书可与作为 Red Hat Advanced Cluster Management 应用程序管理一部分的 Git 频道关联。如需了解更多详细信息,请参阅使用自定义 CA 证书进行安全 HTTPS 连接。

Helm 频道允许您禁用证书验证。禁用证书验证的 Helm 频道,必须在开发环境中配置。禁用证书验证会带来安全隐患。

1.1.3.2. 受管集群证书

证书用于使用 hub 验证受管集群。因此,了解与这些证书关联的故障排除方案非常重要。如需了解更多详细信息,请参阅证书更改后离线清理的集群。

受管集群证书会自动刷新。

1.1.4. 第三方证书

1.1.4.1. 轮转 gatekeeper Webhook 证书

完成以下步骤以轮转 gatekeeper Webhook 证书:

使用以下命令编辑包含证书的 secret:

oc edit secret -n openshift-gatekeeper-system gatekeeper-webhook-server-cert-

删除

data部分中的以下内容:ca.crt、ca.key、tls.crt' 和tls.key。 使用以下命令删除

gatekeeper-controller-managerpod 来重启 gatekeeper Webhook 服务:oc delete po -n openshift-gatekeeper-system -l control-plane=controller-manager

gatekeeper Webhook 证书被轮转。

1.1.4.2. 轮转完整性 shield Webhook 证书(技术预览)

完成以下步骤以轮转完整性 shield Webhook 证书:

编辑 IntegrityShield 自定义资源,把

integrity-shield-operator-system命名空间添加到inScopeNamespaceSelector设置中的命名空间排除列表中。运行以下命令编辑资源:oc edit integrityshield integrity-shield-server -n integrity-shield-operator-system运行以下命令,删除包含 shield 证书的 secret:

oc delete secret -n integrity-shield-operator-system ishield-server-tls删除 Operator,以便重新创建 secret。确保 Operator pod 名称与系统中的 pod 名称匹配。运行以下命令:

oc delete po -n integrity-shield-operator-system integrity-shield-operator-controller-manager-64549569f8-v4pz6删除完整 shield 服务器 pod,以使用以下命令开始使用新证书:

oc delete po -n integrity-shield-operator-system integrity-shield-server-5fbdfbbbd4-bbfbz

在受管集群中使用证书策略控制器来创建和管理证书策略。请参阅策略控制器以了解更多有关控制器的信息。返回到风险和合规页面以了解更多信息。

1.2. 替换管理入口证书

如果您不想使用 OpenShift 默认入口证书,您可以通过更新 Red Hat Advanced Cluster Management for Kubernetes 路由来替换管理入口证书。

1.2.1. 替换管理入口证书的先决条件

将您的 management-ingress 证书和私钥准备妥当。如果需要,您可以使用 OpenSSL 生成 TLS 证书。将证书上的通用名称参数 CN 设置为 manangement-ingress。如果您要生成证书,请加入以下设置:

在您的证书主题备用名称(SAN)列表中包括 Red Hat Advanced Cluster Management for Kubernetes 的路由名称作为域名。

运行以下命令来接收路由名称:

oc get route -n open-cluster-management您可能会收到以下响应:

multicloud-console.apps.grchub2.dev08.red-chesterfield.com

1.2.1.1. 用于生成证书的示例配置文件

以下示例配置文件和 OpenSSL 命令提供了有关如何使用 OpenSSL 生成 TLS 证书的示例。查看以下 csr.cnf 配置文件,该文件定义了用来使用 OpenSSL 生成证书的配置设置。

[ req ] # Main settings

default_bits = 2048 # Default key size in bits.

prompt = no # Disables prompting for certificate values so the configuration file values are used.

default_md = sha256 # Specifies the digest algorithm.

req_extensions = req_ext # Specifies the configuration file section that includes any extensions.

distinguished_name = dn # Specifies the section that includes the distinguished name information.

[ dn ] # Distinguished name settings

C = US # Country

ST = North Carolina # State or province

L = Raleigh # Locality

O = Red Hat Open Shift # Organization

OU = Red Hat Advanced Container Management # Organizational unit

CN = management-ingress # Common name.

[ req_ext ] # Extensions

subjectAltName = @alt_names # Subject alternative names

[ alt_names ] # Subject alternative names

DNS.1 = multicloud-console.apps.grchub2.dev08.red-chesterfield.com

[ v3_ext ] # x509v3 extensions

authorityKeyIdentifier=keyid,issuer:always # Specifies the public key that corresponds to the private key that is used to sign a certificate.

basicConstraints=CA:FALSE # Indicates whether the certificate is a CA certificate during the certificate chain verification process.

#keyUsage=keyEncipherment,dataEncipherment # Defines the purpose of the key that is contained in the certificate.

extendedKeyUsage=serverAuth # Defines the purposes for which the public key can be used.

subjectAltName=@alt_names # Identifies the subject alternative names for the identify that is bound to the public key by the CA.

备注:请必使用您的管理入口的正确主机名更新标记的 SAN,即 DNS.1。

1.2.1.2. 用于生成证书的 OpenSSL 命令

以下 OpenSSL 命令与上述配置文件一同用来生成所需的 TLS 证书。

生成您的证书颁发机构 (CA) RSA 私钥:

openssl genrsa -out ca.key 4096使用您的 CA 密钥生成自签名 CA 证书:

openssl req -x509 -new -nodes -key ca.key -subj "/C=US/ST=North Carolina/L=Raleigh/O=Red Hat OpenShift" -days 400 -out ca.crt为您的证书生成 RSA 私钥:

openssl genrsa -out ingress.key 4096使用私钥生成证书签名请求 (CSR):

openssl req -new -key ingress.key -out ingress.csr -config csr.cnf使用您的 CA 证书和密钥及 CSR 生成签名证书:

openssl x509 -req -in ingress.csr -CA ca.crt -CAkey ca.key -CAcreateserial -out ingress.crt -sha256 -days 300 -extensions v3_ext -extfile csr.cnf检查证书内容:

openssl x509 -noout -text -in ./ingress.crt

1.2.2. 替换自带 (BYO) 入口证书

完成以下步骤以替换您的 BYO 入口证书:

使用您的证书和私钥创建

byo-ingress-tlssecret。运行以下命令:oc -n open-cluster-management create secret tls byo-ingress-tls-secret --cert ./ingress.crt --key ./ingress.key使用以下命令验证是否在正确的命名空间中创建了 secret:

oc get secret -n open-cluster-management | grep -e byo-ingress-tls-secret -e byo-ca-cert可选:运行以下命令,创建包含 CA 证书的 secret:

oc -n open-cluster-management create secret tls byo-ca-cert --cert ./ca.crt --key ./ca.key删除

management-ingress订阅以重新部署订阅。前面步骤中创建的 secret 会被自动使用。运行以下命令:oc delete subscription management-ingress-sub -n open-cluster-management- 验证当前证书是您的证书,并且所有控制台访问和登录功能保持不变。

1.2.3. 恢复管理入口的默认自签名证书

使用以下命令删除您自己的证书 secret:

oc delete secret byo-ca-cert byo-ingress-tls-secret -n open-cluster-management删除

management-ingress订阅以重新部署订阅。前面步骤中创建的 secret 会被自动使用。运行以下命令:oc delete subscription management-ingress-sub -n open-cluster-management- 验证当前证书是您的证书,并且所有控制台访问和登录功能保持不变。

如需有关由 Red Hat Advanced Cluster Management 创建和管理的证书的更多信息,请参阅证书。返回到风险和合规页面以了解更多有关保护集群的信息。

第 2 章 监管

对于在私有云、多云和混合云环境中部署的工作负载,企业必须满足内部对软件工程、安全工程、弹性、安全性以及规范标准的要求。Red Hat Advanced Cluster Management for Kubernetes 监管功能为企业引进自己的安全策略提供了一个可扩展的策略框架。

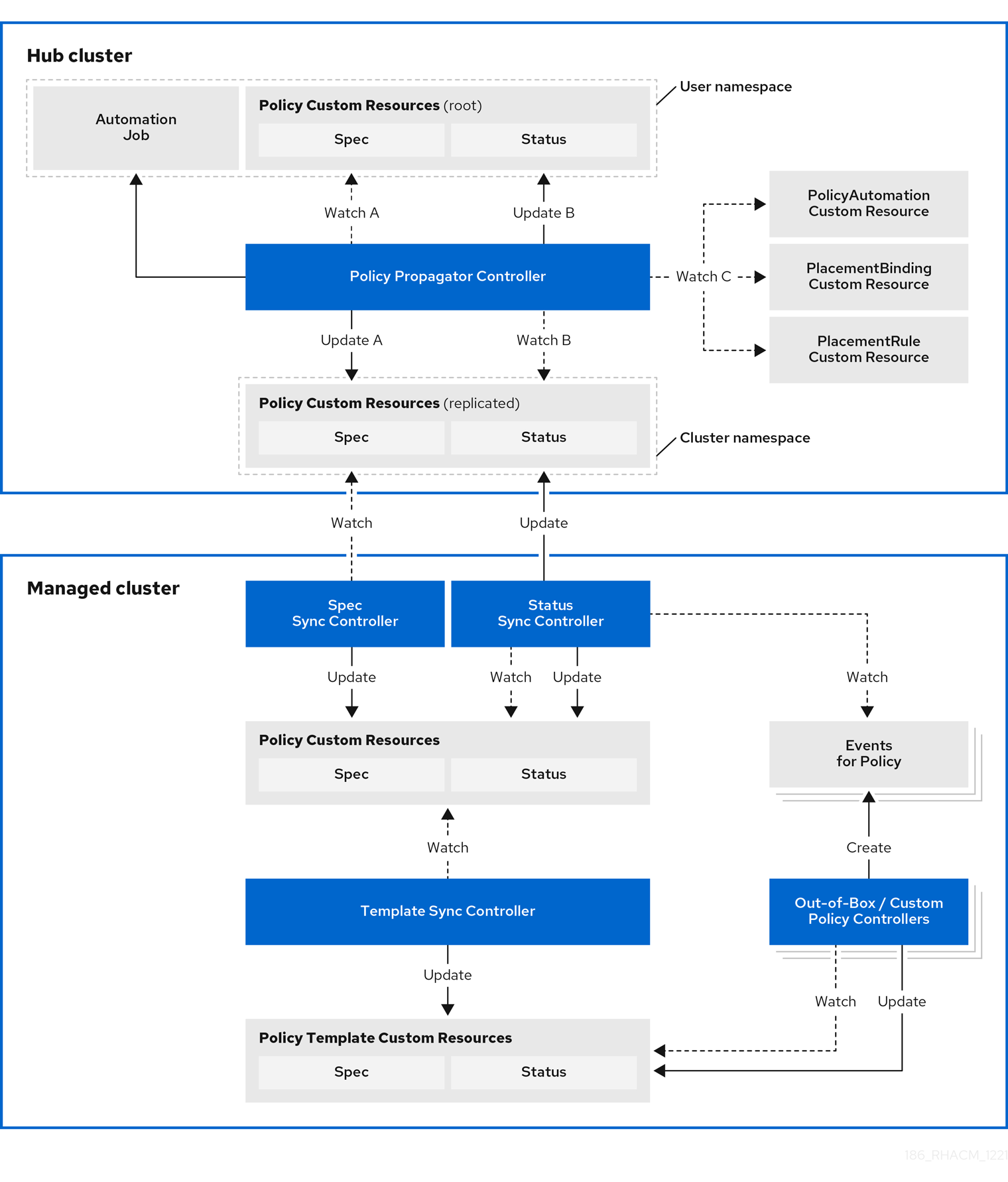

2.1. 监管架构

使用 Red Hat Advanced Cluster Management for Kubernetes 监管声明周期来增强集群的安全性。产品监管生命周期基于定义的策略、流程和程序,以便可以通过一个中央接口页面来管理安全性和合规性。参阅以下监管架构图:

监管架构由以下组件组成:

监管仪表板:提供云监管和风险详情的概述信息,其中包括策略和集群违反情况。

备注:

-

当策略传播到受管集群时,复制策略会命名为

namespaceName.policyName。创建策略时,请确保namespaceName.policyName的长度不得超过 63 个字符,因为 Kubernetes 对对象名称有限制。 -

当您在 hub 集群中搜索策略时,您可能还会在受管集群上收到复制策略的名称。例如,如果搜索

policy-dhaz-cert,则可能出现来自 hub 集群中的以下策略名称:default.policy-dhaz-cert。

-

当策略传播到受管集群时,复制策略会命名为

基于策略的监管框架: 支持根据与集群关联的属性(如一个地区)支持策略创建和部署到各种受管集群。请参阅

policy-collection存储库,以查看预定义的策略示例,以及向集群部署策略的说明。您还可以贡献自定义策略控制器和策略。违反策略时,可将自动化配置为运行并采取用户选择的任何操作。如需更多信息,请参阅配置 Ansible Tower 以了解监管。使用

policy_governance_info指标查看趋势并分析任何策略故障。如需了解更多详细信息,请参阅监管指标。- 策略控制器:根据您的指定控制在受管集群中评估一个或多个策略,并为违反行为生成 Kubernetes 事件。违反行为会被传播到 hub 集群中。安装中包含的策略控制器如下: Kubernetes 配置、证书和 IAM。您还可以创建自定义策略控制器。

-

开源社区:在 Red Hat Advanced Cluster Management 策略框架的基础上支持社区贡献。策略控制器和第三方策略也是

stostron/policy-collection存储库的一部分。了解如何使用 GitOps 贡献和部署策略。如需更多信息,请参阅使用 GitOps 部署策略。了解如何将第三方策略与 Red Hat Advanced Cluster Management for Kubernetes 集成。如需更多信息,请参阅集成第三方策略控制器。

了解 Red Hat Advanced Cluster Management for Kubernetes 策略的结构,以及如何使用 Red Hat Advanced Cluster Management for Kubernetes 监管仪表板。

2.2. 策略概述

使用 Red Hat Advanced Cluster Management for Kubernetes 安全策略框架,以创建自定义策略控制器和其他策略。Kubernetes 自定义资源定义(CRD)实例用于创建策略。有关 CRD 的更多信息,请参阅使用 CustomResourceDefinitions 扩展 Kubernetes API。

每个 Red Hat Advanced Cluster Management for Kubernetes 策略可以至少有一个或多个模板。有关策略元素的更多详情,请参阅本页面的以下策略 YAML 表部分。

策略需要一个 PlacementRule 或 Placement,用于定义策略文档应用到的集群,以及将 Red Hat Advanced Cluster Management for Kubernetes 策略绑定到放置规则的 PlacementBinding。有关如何定义 PlacementRule 的更多信息,请参阅应用程序生命周期文档中的放置规则。有关如何定义 放置 的更多信息,请参阅集群生命周期文档中的 放置概述。

重要:

您必须创建

PlacementBinding,并将它与PlacementRule或Placement关联。最佳实践 :在使用

Placement资源时,使用命令行界面(CLI) 来更新策略。- 除集群命名空间外,您可在 hub 集群上的任意命名空间中创建策略。如果在集群命名空间中创建策略,则 Red Hat Advanced Cluster Management for Kubernetes 会将其删除。

- 每个客户端和供应商负责确保其受管云环境满足适用于 Kubernetes 集群上托管的工作负载的内部软件工程、安全工程、弹性、安全性以及合规性企业安全标准。使用监管和安全功能来提高可见性并对配置进行修复,以满足标准。

在以下部分了解更多有关策略组件的详细信息:

2.2.1. 策略 YAML 结构

创建策略时,必须包含所需的参数字段和值。根据您的策略控制器,您可能需要包含其他可选字段和值。查看解释的参数字段的以下 YAML 结构:

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

name:

annotations:

policy.open-cluster-management.io/standards:

policy.open-cluster-management.io/categories:

policy.open-cluster-management.io/controls:

spec:

policy-templates:

- objectDefinition:

apiVersion:

kind:

metadata:

name:

spec:

remediationAction:

disabled:

---

apiVersion: apps.open-cluster-management.io/v1

kind: PlacementBinding

metadata:

name:

placementRef:

name:

kind:

apiGroup:

subjects:

- name:

kind:

apiGroup:

---

apiVersion: apps.open-cluster-management.io/v1

kind: PlacementRule

metadata:

name:

spec:

clusterConditions:

- type:

clusterLabels:

matchLabels:

cloud:2.2.2. 策略 YAML 表

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| metadata.annotations | 可选。用于指定一组描述策略试图验证的标准集合的安全详情。这里介绍的所有注解都以逗号分隔的字符串表示。注:您可以在控制台中根据您在策略页面上为策略定义的标准和类别查看策略违反。 |

| annotations.policy.open-cluster-management.io/standards | 与策略相关的安全标准的名称。例如,美国国家标准与技术研究院 (NIST) 和支付卡行业 (PCI)。 |

| annotations.policy.open-cluster-management.io/categories | 安全控制类别是针对一个或多个标准的具体要求。例如,系统和信息完整性类别可能表明您的策略包含一个数据传输协议来保护个人信息,符合 HIPAA 和 PCI 标准的要求。 |

| annotations.policy.open-cluster-management.io/controls | 正在接受检查的安全控制名称。例如,证书策略控制器。 |

| spec.policy-templates | 必需。用于创建一个或多个应用到受管集群的策略。 |

| spec.disabled |

必需。将值设为 |

| spec.remediationAction |

可选。指定您的策略的修复。参数值是 |

2.2.3. 策略示例文件

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

name: policy-role

annotations:

policy.open-cluster-management.io/standards: NIST SP 800-53

policy.open-cluster-management.io/categories: AC Access Control

policy.open-cluster-management.io/controls: AC-3 Access Enforcement

spec:

remediationAction: inform

disabled: false

policy-templates:

- objectDefinition:

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name: policy-role-example

spec:

remediationAction: inform # the policy-template spec.remediationAction is overridden by the preceding parameter value for spec.remediationAction.

severity: high

namespaceSelector:

include: ["default"]

object-templates:

- complianceType: mustonlyhave # role definition should exact match

objectDefinition:

apiVersion: rbac.authorization.k8s.io/v1

kind: Role

metadata:

name: sample-role

rules:

- apiGroups: ["extensions", "apps"]

resources: ["deployments"]

verbs: ["get", "list", "watch", "delete","patch"]

---

apiVersion: policy.open-cluster-management.io/v1

kind: PlacementBinding

metadata:

name: binding-policy-role

placementRef:

name: placement-policy-role

kind: PlacementRule

apiGroup: apps.open-cluster-management.io

subjects:

- name: policy-role

kind: Policy

apiGroup: policy.open-cluster-management.io

---

apiVersion: apps.open-cluster-management.io/v1

kind: PlacementRule

metadata:

name: placement-policy-role

spec:

clusterConditions:

- status: "True"

type: ManagedClusterConditionAvailable

clusterSelector:

matchExpressions:

- {key: environment, operator: In, values: ["dev"]}2.2.4. 放置 YAML 示例文件

PlacementBinding 和 Placement 资源可以与上一策略示例结合使用,以使用集群 Placement API 而非 PlacementRule API 部署策略。

---

apiVersion: policy.open-cluster-management.io/v1

kind: PlacementBinding

metadata:

name: binding-policy-role

placementRef:

name: placement-policy-role

kind: Placement

apiGroup: cluster.open-cluster-management.io

subjects:

- name: policy-role

kind: Policy

apiGroup: policy.open-cluster-management.io

---

//Depends on if governance would like to use v1beta1

apiVersion: cluster.open-cluster-management.io/v1beta1

kind: Placement

metadata:

name: placement-policy-role

spec:

predicates:

- requiredClusterSelector:

labelSelector:

matchExpressions:

- {key: environment, operator: In, values: ["dev"]}请参阅管理安全策略以创建和更新策略。您还可以启用和更新 Red Hat Advanced Cluster Management 策略控制器,以验证您的策略合规性。请参阅策略控制器。

要了解更多策略主题,请参阅监管。

2.3. 策略控制器

策略控制器监控并报告集群是否合规。通过开箱即用的策略模板应用预定义策略控制器和策略,以使用 Red Hat Advanced Cluster Management for Kubernetes 策略框架。策略控制器是 Kubernetes 自定义资源定义(CRD)实例。

有关 CRD 的更多信息,请参阅使用 CustomResourceDefinitions 扩展 Kubernetes API。策略控制器会修复策略违反情况,以使集群状态兼容。

您可以使用产品策略框架创建自定义策略和策略控制器。如需更多信息,请参阅 创建自定义策略控制器(已弃用)。

查看以下主题以了解有关以下 Red Hat Advanced Cluster Management for Kubernetes 策略控制器的更多信息:

重要 :只有配置策略控制器策略支持 enforce 功能。当策略控制器不支持 enforce 功能时,您必须手动修复策略。

有关管理您的策略的更多主题,请参阅监管。

2.3.1. Kubernetes 配置策略控制器

配置策略控制器可用于配置任何 Kubernetes 资源,并在集群中应用安全策略。

配置策略控制器与本地 Kubernetes API 服务器通信,以获取集群中的配置列表。有关 CRD 的更多信息,请参阅使用 CustomResourceDefinitions 扩展 Kubernetes API。

配置策略控制器是在安装过程中在 hub 集群上创建的。配置策略控制器支持 enforce 功能并监控以下策略的合规性:

当将配置策略的 remediationAction 设置为 enforce 时,控制器会在目标受管集群上创建副本策略。您还可以在配置策略中使用模板。如需更多信息,请参阅配置策略中的模板支持。

继续读取以了解更多有关配置策略控制器的信息:

2.3.1.1. 配置策略控制器 YAML 结构

Name: configuration-policy-example

Namespace:

Labels:

APIVersion: policy.open-cluster-management.io/v1

Kind: ConfigurationPolicy

Metadata:

Finalizers:

finalizer.policy.open-cluster-management.io

Spec:

Conditions:

Ownership:

NamespaceSelector:

Exclude:

Include:

RemediationAction:

Status:

CompliancyDetails:

Configuration-Policy-Example:

Default:

Kube - Public:

Compliant: Compliant

Events:2.3.1.2. 配置策略示例

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name: policy-config

spec:

namespaceSelector:

include: ["default"]

exclude: []

remediationAction: inform

severity: low

object-templates:

- complianceType: musthave

objectDefinition:

apiVersion: v1

kind: Pod

metadata:

name: pod

spec:

containers:

- image: 'pod-image'

name:

ports:

- containerPort: 80

evaluationInterval:

compliant:

noncompliant:2.3.1.3. 配置策略 YAML 标

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。策略的名称。 |

| spec | 必需。有关监控哪些配置策略以及如何进行修复的规格。 |

| spec.namespace |

命名空间对象或资源是必需的。策略应用到的 hub 集群中的命名空间。至少为 |

| spec.remediationAction |

必需。指定您的策略的修复。输入 |

| spec.remediationAction.severity |

必需。当策略不合规时,指定严重性。使用以下参数值: |

| spec.remediationAction.complianceType | 必需。用于列出必须被评估或应用到受管集群的角色的预期行为和任何 Kubernetes 对象。您必须使用以下操作动词作为参数值:

|

| spec.evaluationInterval.compliant |

可选。用于定义策略处于合规状态时的评估频率。该值的格式必须是一个持续时间,它是带有时间单元后缀的数字序列。例如: |

| spec.evaluationInterval.noncompliant |

可选。用于定义策略处于不合规状态时的频率。与 |

请参阅 CM-Configuration-Management 目录获取使用NIST Special Publication 800-53 (Rev. 4) 的,被 Red Hat Advanced Cluster Management 支持的策略示例。了解策略如何应用到您的 hub 集群,请参阅支持的策略以了解更多详细信息。

2.3.2. 证书策略控制器

证书策略控制器可以用来检测快要到期的证书,并检测时间太长(小时)或包含无法与指定模式匹配的 DNS 名称。

通过更新控制器策略中的以下参数来配置和自定义证书策略控制器:

-

minimumDuration -

minimumCADuration -

maximumDuration -

maximumCADuration -

allowedSANPattern -

disallowedSANPattern

由于以下情况之一,您的策略可能会变得不合规:

- 当证书过期的时间少于最短持续时间,或超过最长时间时。

- 当 DNS 名称与指定模式匹配时。

证书策略控制器是在受管集群上创建的。控制器与本地 Kubernetes API 服务器通信,以获取包含证书的 secret 列表,并确定所有不合规的证书。有关 CRD 的更多信息,请参阅使用 CustomResourceDefinitions 扩展 Kubernetes API。

证书策略控制器不支持 enforce 功能。

2.3.2.1. 证书策略控制器 YAML 结构

查看证书策略的以下示例,并查看 YAML 表中的元素:

apiVersion: policy.open-cluster-management.io/v1

kind: CertificatePolicy

metadata:

name: certificate-policy-example

namespace:

labels: category=system-and-information-integrity

spec:

namespaceSelector:

include: ["default"]

remediationAction:

severity:

minimumDuration:

minimumCADuration:

maximumDuration:

maximumCADuration:

allowedSANPattern:

disallowedSANPattern:2.3.2.1.1. 证书策略控制器 YAML 表

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略的名称。 |

| metadata.namespace | 必需。创建了策略的受管集群内命名空间。 |

| metadata.labels |

可选。在证书策略中, |

| spec | 必需。有关要监控和刷新哪些证书的规格。 |

| spec.namespaceSelector |

必需。要将策略应用到的受管集群命名空间。输入

• 当您创建多个证书策略并将其应用到同一受管集群时,必须为每个策略

• 如果证书策略控制器的 |

| spec.remediationAction |

必需。指定您的策略的修复。将参数值设置为 |

| spec.severity |

可选。当策略不合规时,会告知用户的严重性。使用以下参数值: |

| spec.minimumDuration |

必需。如果没有指定值,则默认为 |

| spec.minimumCADuration |

可选。设定一个与其他证书不同的值来标识可能很快过期的签名证书。如果没有指定参数值,则 CA 证书过期时间作为 |

| spec.maximumDuration | 可选。指定一个值来标识创建的时间超过您所期望的限制值的证书。参数使用 Golang 的持续时间格式。如需更多信息,请参阅 Golang 解析持续时间。 |

| spec.maximumCADuration | 可选。创建一个值来标识创建的时间超过您定义的限制值的签名的证书。参数使用 Golang 的持续时间格式。如需更多信息,请参阅 Golang 解析持续时间。 |

| spec.allowedSANPattern | 可选。正则表达式,必须与您证书中定义的每个 SAN 条目匹配。这个参数会根据特征检查 DNS 名称。如需更多信息,请参阅 Golang 郑则表达式语法。 |

| spec.disallowedSANPattern |

可选。正则表达式,不能与证书中定义的任何 SAN 条目匹配。这个参数根据模式检查 DNS 名称。 如需更多信息,请参阅 Golang 郑则表达式语法。 |

2.3.2.2. 证书策略示例

当在 hub 集群上创建证书策略控制器时,会在受管集群上创建复制策略。请参阅 policy-certificate.yaml 查看证书策略示例。

2.3.3. IAM 策略控制器

Identity and Access Management (IAM) 策略控制器可以用来接收有关不合规的 IAM 策略的通知。合规性检查是基于您在 IAM 策略中配置的参数。

IAM 策略控制器监控集群中具有特定集群角色(例如 ClusterRole)所需的最大数量用户数。要监控的默认集群角色是 cluster-admin。IAM 策略控制器与本地 Kubernetes API 服务器通信。如需更多信息,请参阅使用 CustomResourceDefinitions 扩展 Kubernetes API。

IAM 策略控制器在您的受管集群上运行。查看以下部分以了解更多信息:

2.3.3.1. IAM 策略 YAML 结构

查看 IAM 策略的以下示例,并查看 YAML 表中的参数:

apiVersion: policy.open-cluster-management.io/v1

kind: IamPolicy

metadata:

name:

spec:

clusterRole:

severity:

remediationAction:

maxClusterRoleBindingUsers:

ignoreClusterRoleBindings:2.3.3.2. IAM 策略 YAML 表

查看以下参数表以获详细信息:

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| spec | 必需。添加策略的配置详情。 |

| spec.clusterRole |

可选。要监控的集群角色(如 |

| spec.severity |

可选。当策略不合规时,会告知用户的严重性。使用以下参数值: |

| spec.remediationAction |

可选。指定您的策略的修复。输入 |

| spec.ignoreClusterRoleBindings |

可选。正则表达式(regex)值列表,指示要忽略的集群角色绑定名称。这些正则表达式值必须遵循 Go regexp 语法。默认情况下,所有具有以 |

| spec.maxClusterRoleBindingUsers | 必需。在策略被视为不合规前可用的 IAM rolebinding 的最大数量。 |

2.3.3.3. IAM 策略示例

请参阅 policy-limitclusteradmin.yaml 查看 IAM 策略示例。如需更多信息,请参阅管理安全策略。

如需更多主题,请参阅策略控制器。

2.3.4. 策略控制器

策略控制器将策略状态范围聚合到同一命名空间中定义的策略。创建策略集合(PolicySet),以对同一命名空间中的策略进行分组。PolicySet 中的所有策略都放在选定集群中,方法是创建一个 PlacementBinding 来绑定 PolicySet 和 Placement。策略集已部署到 hub 集群。

另外,当策略是多个策略集的一部分时,现有和新的 Placement 资源保留在策略中。当用户从策略集合中删除策略时,策略不会应用到在策略集合中选择的集群,但放置会保留。策略控制器只检查包括策略设置放置的集群中的违反情况。

注: Red Hat Advanced Cluster Management 强化示例策略集使用集群放置。如果使用集群放置,请将包含策略的命名空间绑定到受管集群集。有关使用集群放置的详情,请参阅在集群中部署策略。

在以下部分了解更多有关策略设置结构的详细信息:

2.3.4.1. 策略设置 YAML 结构

您的策略集可能类似以下 YAML 文件:

apiVersion: policy.open-cluster-management.io/v1beta1

kind: PolicySet

metadata:

name: demo-policyset

spec:

policies:

- policy-demo

---

apiVersion: policy.open-cluster-management.io/v1

kind: PlacementBinding

metadata:

name: demo-policyset-pb

placementRef:

apiGroup: apps.open-cluster-management.io

kind: PlacementRule

name: demo-policyset-pr

subjects:

- apiGroup: policy.open-cluster-management.io

kind: PolicySet

name: demo-policyset

---

apiVersion: apps.open-cluster-management.io

kind: PlacementRule

metadata:

name: demo-policyset-pr

spec:

clusterConditions:pagewidth:

- status: "True"

type: ManagedCLusterConditionAvailable

clusterSelectors:

matchExpressions:

- key: name

operator: In

values:

- local-cluster2.3.4.2. 策略设置表

查看以下参数表以获详细信息:

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| spec | 必需。添加策略的配置详情。 |

| spec.policies | 可选。要在策略集合中分组的策略列表。 |

2.3.4.3. 策略示例

apiVersion: policy.open-cluster-management.io/v1beta1

kind: PolicySet

metadata:

name: pci

namespace: default

spec:

description: Policies for PCI compliance

policies:

- policy-pod

- policy-namespace

status:

compliant: NonCompliant

placement:

- placementBinding: binding1

placementRule: placement1

policySet: policyset-ps

请参阅管理安全策略部分中的创建策略部分。另外,查看 stable PolicySets,它要求策略生成器用于部署,PolicySets- Stable。请参阅策略生成器文档。

2.3.5. 创建自定义策略控制器(已弃用)

了解如何编写、应用、查看和更新您的自定义策略控制器。您可以为策略控制器创建 YAML 文件,以部署到集群中。查看以下部分以创建策略控制器:

2.3.5.1. 编写一个策略控制器

使用位于 Govern-policy-framework 存储库中的策略控制器框架。完成以下步骤来创建策略控制器:

运行以下命令克隆

governance-policy-framework存储库:git clone git@github.com:stolostron/governance-policy-framework.git通过更新策略模式定义自定义控制器策略。您的策略可能类似以下内容:

metadata: name: samplepolicies.policies.open-cluster-management.io spec: group: policy.open-cluster-management.io names: kind: SamplePolicy listKind: SamplePolicyList plural: samplepolicies singular: samplepolicy更新策略控制器以监视

SamplePolicykind。运行以下命令:for file in $(find . -name "*.go" -type f); do sed -i "" "s/SamplePolicy/g" $file; done for file in $(find . -name "*.go" -type f); do sed -i "" "s/samplepolicy-controller/samplepolicy-controller/g" $file; done通过完成以下步骤重新编译并运行策略控制器:

- 登录到您的集群。

- 选择用户图标,然后点击 Configure client。

- 将配置信息复制并粘贴到您的命令行中,然后按 Enter 键。

运行以下命令以应用您的策略 CRD 并启动控制器:

export GO111MODULE=on kubectl apply -f deploy/crds/policy.open-cluster-management.io_samplepolicies_crd.yaml export WATCH_NAMESPACE=<cluster_namespace_on_hub> go run cmd/manager/main.go您可能会收到以下输出来表示控制器在运行:

{“level”:”info”,”ts”:1578503280.511274,”logger”:”controller-runtime.manager”,”msg”:”starting metrics server”,”path”:”/metrics”} {“level”:”info”,”ts”:1578503281.215883,”logger”:”controller-runtime.controller”,”msg”:”Starting Controller”,”controller”:”samplepolicy-controller”} {“level”:”info”,”ts”:1578503281.3203468,”logger”:”controller-runtime.controller”,”msg”:”Starting workers”,”controller”:”samplepolicy-controller”,”worker count”:1} Waiting for policies to be available for processing…创建策略,验证控制器是否已检索策略,并在集群中应用策略。运行以下命令:

kubectl apply -f deploy/crds/policy.open-cluster-management.io_samplepolicies_crd.yaml应用策略时,会出现一条消息来指示您的自定义控制器监控并检测到策略。这个信息可能类似以下内容:

{"level":"info","ts":1578503685.643426,"logger":"controller_samplepolicy","msg":"Reconciling SamplePolicy","Request.Namespace":"default","Request.Name":"example-samplepolicy"} {"level":"info","ts":1578503685.855259,"logger":"controller_samplepolicy","msg":"Reconciling SamplePolicy","Request.Namespace":"default","Request.Name":"example-samplepolicy"} Available policies in namespaces: namespace = kube-public; policy = example-samplepolicy namespace = default; policy = example-samplepolicy namespace = kube-node-lease; policy = example-samplepolicy运行以下命令,检查

status字段中的合规详情:kubectl describe SamplePolicy example-samplepolicy -n default您的输出可能类似以下内容:

status: compliancyDetails: example-samplepolicy: cluster-wide: - 5 violations detected in namespace `cluster-wide`, there are 0 users violations and 5 groups violations default: - 0 violations detected in namespace `default`, there are 0 users violations and 0 groups violations kube-node-lease: - 0 violations detected in namespace `kube-node-lease`, there are 0 users violations and 0 groups violations kube-public: - 1 violations detected in namespace `kube-public`, there are 0 users violations and 1 groups violations compliant: NonCompliant更改策略规则和策略逻辑,为您的策略控制器引入新规则。完成以下步骤:

通过更新

SamplePolicySpec在 YAML 文件中添加新字段 。您的规格应该和以下类似:spec: description: SamplePolicySpec defines the desired state of SamplePolicy properties: labelSelector: additionalProperties: type: string type: object maxClusterRoleBindingGroups: type: integer maxClusterRoleBindingUsers: type: integer maxRoleBindingGroupsPerNamespace: type: integer maxRoleBindingUsersPerNamespace: type: integer-

使用新字段在 samplepolicy_controller.go 中更新

SamplePolicySpec的数据结构。 -

使用新的路径更新

samplepolicy_controller.go文件中的PeriodicallyExecSamplePolicies函数来运行策略控制器。查看PeriodicallyExecSamplePolicies字段的示例,请参阅 stolostron/multicloud-operators-policy-controller。 - 重新编译并运行策略控制器。请参阅编写策略控制器

您的策略控制器可以正常工作。

2.3.5.2. 将控制器部署到集群中

将自定义策略控制器部署到集群,并将策略控制器与监管仪表板集成。完成以下步骤:

运行以下命令构建策略控制器镜像:

make build docker build . -f build/Dockerfile -t <username>/multicloud-operators-policy-controller:latest运行以下命令将镜像推送到您选择的仓库中。例如,运行以下命令将镜像 push 到 Docker Hub:

docker login docker push <username>/multicloud-operators-policy-controller-

配置

kubectl以指向由 Red Hat Advanced Cluster Management for Kubernetes 管理的集群。 替换 operator 清单以使用内置镜像名称,并更新命名空间以监视策略。命名空间必须是集群的命名空间。您的清单可能类似以下内容:

sed -i "" 's|stolostron/multicloud-operators-policy-controller|ycao/multicloud-operators-policy-controller|g' deploy/operator.yaml sed -i "" 's|value: default|value: <namespace>|g' deploy/operator.yaml运行以下命令更新 RBAC 角色:

sed -i "" 's|samplepolicies|testpolicies|g' deploy/cluster_role.yaml sed -i "" 's|namespace: default|namespace: <namespace>|g' deploy/cluster_role_binding.yaml将策略控制器部署到集群中:

运行以下命令为集群设置服务帐户:

kubectl apply -f deploy/service_account.yaml -n <namespace>运行以下命令来为 operator 创建 RBAC:

kubectl apply -f deploy/role.yaml -n <namespace> kubectl apply -f deploy/role_binding.yaml -n <namespace>为您的策略控制器设置 RBAC。运行以下命令:

kubectl apply -f deploy/cluster_role.yaml kubectl apply -f deploy/cluster_role_binding.yaml运行以下命令来设置自定义资源定义(CRD):

kubectl apply -f deploy/crds/policies.open-cluster-management.io_samplepolicies_crd.yaml运行以下命令来部署

multicloud-operator-policy-controller:kubectl apply -f deploy/operator.yaml -n <namespace>运行以下命令验证控制器是否正常工作:

kubectl get pod -n <namespace>

-

您必须通过为控制器创建一个

策略模板来集成您的策略控制器。如需更多信息,请参阅通过控制台创建集群安全策略。

2.3.5.2.1. 扩展控制器部署

策略控制器部署不支持删除。您可以扩展部署,以更新部署应用到哪些 pod。完成以下步骤:

- 登录到受管集群。

- 导航到自定义策略控制器的部署。

- 扩展部署。当将部署扩展到零个 pod 时,策略控制程序部署将被禁用。

如需有关部署的更多信息,请参阅 OpenShift Container Platform 部署。

您的策略控制器已部署并在集群中集成。如需更多信息,请参阅策略控制器。

2.4. 集成第三方策略控制器

集成第三方策略,在策略模板中创建自定义注解,以指定一个或多个合规标准、控制类别和控制。

您还可以使用来自 policy-collection/community 中的第三方策略。

了解如何集成以下第三方策略:

2.4.1. 集成 gatekeeper 约束和约束模板

Gatekeeper 是一个验证 webhook,它强制执行基于自定义资源定义(CRD)的策略,该策略与 Open Policy Agent(OPA)一起运行。您可以使用 gatekeeper operator 策略在集群中安装 gatekeeper。Gatekeeper 策略可用于评估 Kubernetes 资源合规性。您可以使用 OPA 作为策略引擎,并使用 Rego 作为策略语言。

gatekeeper 策略在 Red Hat Advanced Cluster Management 中作为 Kubernetes 配置策略创建。Gatekeeper 策略包括约束模板(ConstraintTemplates)和 Constraints、审计模板和准入模板。如需更多信息,请参阅 Gatekeeper 上游存储库。

Red Hat Advanced Cluster Management 支持 Gatekeeper 版本 3.3.0,并在 Red Hat Advanced Cluster Management gatekeeper 策略中应用以下约束模板:

ConstraintTemplates和约束: 使用policy-gatekeeper-k8srequiredlabels策略在受管集群上创建 gatekeeper 约束模板。apiVersion: policy.open-cluster-management.io/v1 kind: ConfigurationPolicy metadata: name: policy-gatekeeper-k8srequiredlabels spec: remediationAction: enforce # will be overridden by remediationAction in parent policy severity: low object-templates: - complianceType: musthave objectDefinition: apiVersion: templates.gatekeeper.sh/v1beta1 kind: ConstraintTemplate metadata: name: k8srequiredlabels spec: crd: spec: names: kind: K8sRequiredLabels validation: # Schema for the `parameters` field openAPIV3Schema: properties: labels: type: array items: string targets: - target: admission.k8s.gatekeeper.sh rego: | package k8srequiredlabels violation[{"msg": msg, "details": {"missing_labels": missing}}] { provided := {label | input.review.object.metadata.labels[label]} required := {label | label := input.parameters.labels[_]} missing := required - provided count(missing) > 0 msg := sprintf("you must provide labels: %v", [missing]) } - complianceType: musthave objectDefinition: apiVersion: constraints.gatekeeper.sh/v1beta1 kind: K8sRequiredLabels metadata: name: ns-must-have-gk spec: match: kinds: - apiGroups: [""] kinds: ["Namespace"] namespaces: - e2etestsuccess - e2etestfail parameters: labels: ["gatekeeper"]audit 模板: 使用

policy-gatekeeper-audit定期检查并评估为检测现有错误配置而强制执行的门管理器策略的现有资源。apiVersion: policy.open-cluster-management.io/v1 kind: ConfigurationPolicy metadata: name: policy-gatekeeper-audit spec: remediationAction: inform # will be overridden by remediationAction in parent policy severity: low object-templates: - complianceType: musthave objectDefinition: apiVersion: constraints.gatekeeper.sh/v1beta1 kind: K8sRequiredLabels metadata: name: ns-must-have-gk status: totalViolations: 0Admission 模板: 使用

policy-gatekeeper-admission检查由 gatekeeper admission webhook 创建的错误配置:apiVersion: policy.open-cluster-management.io/v1 kind: ConfigurationPolicy metadata: name: policy-gatekeeper-admission spec: remediationAction: inform # will be overridden by remediationAction in parent policy severity: low object-templates: - complianceType: mustnothave objectDefinition: apiVersion: v1 kind: Event metadata: namespace: openshift-gatekeeper-system # set it to the actual namespace where gatekeeper is running if different annotations: constraint_action: deny constraint_kind: K8sRequiredLabels constraint_name: ns-must-have-gk event_type: violation

如需了解更多详细信息,请参阅 policy-gatekeeper-sample.yaml。

2.4.2. 策略生成器

策略生成器是 Red Hat Advanced Cluster Management for Kubernetes 应用程序生命周期订阅 GitOps 工作流的一部分,该工作流使用 Kustomize 生成 Red Hat Advanced Cluster Management for Kubernetes 策略。策略生成器从 Kubernetes 清单 YAML 文件构建 Red Hat Advanced Cluster Management for Kubernetes 策略,该文件通过用于配置它的 PolicyGenerator 清单 YAML 文件提供。策略生成器作为 Kustomize 生成器插件实施。有关 Kustomize 的更多信息,请参阅 Kustomize 文档。

此 Red Hat Advanced Cluster Management 版本捆绑的策略生成器版本是 v1.8.0。

2.4.2.1. 策略生成器功能

策略生成器及其与 Red Hat Advanced Cluster Management 应用程序生命周期 订阅 GitOps 工作流的集成简化了 Kubernetes 资源对象的分发到受管 OpenShift 集群,并通过 Red Hat Advanced Cluster Management 策略简化了 Kubernetes 集群的分发。特别是,使用策略生成器完成以下操作:

- 将任何 Kubernetes 清单文件转换为 Red Hat Advanced Cluster Management 配置策略。

- 在将输入 Kubernetes 清单插入到生成的 Red Hat Advanced Cluster Management 策略前对其进行补丁。

- 生成额外的配置策略,以便能够通过 Red Hat Advanced Cluster Management for Kubernetes 报告 Gatekeeper 和 Kyverno 策略违反情况。

- 在 hub 集群上生成策略集。如需了解更多详细信息,请参阅策略设置控制器。

如需更多信息,请查看以下主题:

2.4.2.2. 策略生成器配置结构

策略生成器是一个 Kustomize 生成器插件,它配置了一个 PolicyGenerator kind 和 policy.open-cluster-management.io/v1 API 版本的清单。

要使用该插件,请首先在 kustomization.yaml 文件中添加一个 generators 部分。查看以下示例:

generators:

- policy-generator-config.yaml

上例中引用的 policy-generator-config.yaml 文件是一个 YAML 文件,其中包含要生成的策略的说明。简单的策略生成器配置文件可能类似以下示例:

apiVersion: policy.open-cluster-management.io/v1

kind: PolicyGenerator

metadata:

name: config-data-policies

policyDefaults:

namespace: policies

policySets: []

policies:

- name: config-data

manifests:

- path: configmap.yaml

configmap.yaml 代表要包含在策略中的 Kubernetes 清单 YAML 文件。查看以下示例:

apiVersion: v1

kind: ConfigMap

metadata:

name: my-config

namespace: default

data:

key1: value1

key2: value2

生成的 Policy 以及生成的 PlacementRule 和 PlacementBinding 可能类似以下示例:

apiVersion: apps.open-cluster-management.io/v1

kind: PlacementRule

metadata:

name: placement-config-data

namespace: policies

spec:

clusterConditions:

- status: "True"

type: ManagedClusterConditionAvailable

clusterSelector:

matchExpressions: []

---

apiVersion: policy.open-cluster-management.io/v1

kind: PlacementBinding

metadata:

name: binding-config-data

namespace: policies

placementRef:

apiGroup: apps.open-cluster-management.io

kind: PlacementRule

name: placement-config-data

subjects:

- apiGroup: policy.open-cluster-management.io

kind: Policy

name: config-data

---

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

annotations:

policy.open-cluster-management.io/categories: CM Configuration Management

policy.open-cluster-management.io/controls: CM-2 Baseline Configuration

policy.open-cluster-management.io/standards: NIST SP 800-53

name: config-data

namespace: policies

spec:

disabled: false

policy-templates:

- objectDefinition:

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name: config-data

spec:

object-templates:

- complianceType: musthave

objectDefinition:

apiVersion: v1

data:

key1: value1

key2: value2

kind: ConfigMap

metadata:

name: my-config

namespace: default

remediationAction: inform

severity: low

如需了解更多详细信息,请参阅 policy-generator-plugin 存储库。

2.4.2.3. 生成用于安装 Operator 的策略

Red Hat Advanced Cluster Management 策略的一个常见用途是在一个或多个受管 OpenShift 集群上安装 Operator。查看以下不同安装模式和所需资源的示例。

2.4.2.3.1. 安装 OpenShift GitOps 的策略

本例演示了如何生成一个策略,以使用策略生成器安装 OpenShift GitOps。OpenShift GitOps 操作器 提供所有命名空间 安装模式。首先,需要按照以下示例创建名为 openshift-gitops-subscription.yaml 的订阅清单文件。

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: openshift-gitops-operator

namespace: openshift-operators

spec:

channel: stable

name: openshift-gitops-operator

source: redhat-operators

sourceNamespace: openshift-marketplace

要固定到 Operator 的特定版本,您可以添加以下参数和值: spec.startingCSV: openshift-gitops-operator.v<version>。将 <version> 替换为您的首选版本。

接下来,需要名为 policy-generator-config.yaml 的策略生成器配置文件。以下示例显示了一个策略,它将在所有 OpenShift 受管集群上安装 OpenShift GitOps:

apiVersion: policy.open-cluster-management.io/v1

kind: PolicyGenerator

metadata:

name: install-openshift-gitops

policyDefaults:

namespace: policies

placement:

clusterSelectors:

vendor: "OpenShift"

remediationAction: enforce

policies:

- name: install-openshift-gitops

manifests:

- path: openshift-gitops-subscription.yaml

所需的最后一个文件是 kustomization.yaml 文件。kustomization.yaml 文件需要以下配置:

generators:

- policy-generator-config.yaml生成的策略可能类似以下文件:

apiVersion: apps.open-cluster-management.io/v1

kind: PlacementRule

metadata:

name: placement-install-openshift-gitops

namespace: policies

spec:

clusterConditions:

- status: "True"

type: ManagedClusterConditionAvailable

clusterSelector:

matchExpressions:

- key: vendor

operator: In

values:

- OpenShift

---

apiVersion: policy.open-cluster-management.io/v1

kind: PlacementBinding

metadata:

name: binding-install-openshift-gitops

namespace: policies

placementRef:

apiGroup: apps.open-cluster-management.io

kind: PlacementRule

name: placement-install-openshift-gitops

subjects:

- apiGroup: policy.open-cluster-management.io

kind: Policy

name: install-openshift-gitops

---

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

annotations:

policy.open-cluster-management.io/categories: CM Configuration Management

policy.open-cluster-management.io/controls: CM-2 Baseline Configuration

policy.open-cluster-management.io/standards: NIST SP 800-53

name: install-openshift-gitops

namespace: policies

spec:

disabled: false

policy-templates:

- objectDefinition:

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name: install-openshift-gitops

spec:

object-templates:

- complianceType: musthave

objectDefinition:

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: openshift-gitops-operator

namespace: openshift-operators

spec:

channel: stable

name: openshift-gitops-operator

source: redhat-operators

sourceNamespace: openshift-marketplace

remediationAction: enforce

severity: low所有输入来自 OpenShift Container Platform 文档中的策略,并由策略生成器生成。查看 OpenShift Container Platform 文档中的以下 YAML 输入示例:

如需了解更多详细信息,请参阅 了解 OpenShift GitOps 和 Operator 文档。

2.4.2.3.2. 安装 Compliance Operator 的策略

对于使用 命名空间安装模式的 Operator,如 Compliance Operator,还需要 OperatorGroup 清单。本例演示了安装 Compliance Operator 的生成的策略。

首先,必须创建一个带有 Namespace、Subscription 和名为 compliance-operator.yaml 的 OperatorGroup 清单的 YAML 文件。以下示例将这些清单安装到 compliance-operator 命名空间中:

apiVersion: v1

kind: Namespace

metadata:

name: openshift-compliance

---

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: compliance-operator

namespace: openshift-compliance

spec:

channel: release-0.1

name: compliance-operator

source: redhat-operators

sourceNamespace: openshift-marketplace

---

apiVersion: operators.coreos.com/v1

kind: OperatorGroup

metadata:

name: compliance-operator

namespace: openshift-compliance

spec:

targetNamespaces:

- compliance-operator

接下来,需要名为 policy-generator-config.yaml 的策略生成器配置文件。以下示例显示了在一个 OpenShift 受管集群上安装 Compliance Operator 的单一策略:

apiVersion: policy.open-cluster-management.io/v1

kind: PolicyGenerator

metadata:

name: install-compliance-operator

policyDefaults:

namespace: policies

placement:

clusterSelectors:

vendor: "OpenShift"

remediationAction: enforce

policies:

- name: install-compliance-operator

manifests:

- path: compliance-operator.yaml

所需的最后一个文件是 kustomization.yaml 文件。kustomization.yaml 文件中需要以下配置:

generators:

- policy-generator-config.yaml因此,生成的策略应类似以下文件:

apiVersion: apps.open-cluster-management.io/v1

kind: PlacementRule

metadata:

name: placement-install-compliance-operator

namespace: policies

spec:

clusterConditions:

- status: "True"

type: ManagedClusterConditionAvailable

clusterSelector:

matchExpressions:

- key: vendor

operator: In

values:

- OpenShift

---

apiVersion: policy.open-cluster-management.io/v1

kind: PlacementBinding

metadata:

name: binding-install-compliance-operator

namespace: policies

placementRef:

apiGroup: apps.open-cluster-management.io

kind: PlacementRule

name: placement-install-compliance-operator

subjects:

- apiGroup: policy.open-cluster-management.io

kind: Policy

name: install-compliance-operator

---

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

annotations:

policy.open-cluster-management.io/categories: CM Configuration Management

policy.open-cluster-management.io/controls: CM-2 Baseline Configuration

policy.open-cluster-management.io/standards: NIST SP 800-53

name: install-compliance-operator

namespace: policies

spec:

disabled: false

policy-templates:

- objectDefinition:

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name: install-compliance-operator

spec:

object-templates:

- complianceType: musthave

objectDefinition:

apiVersion: v1

kind: Namespace

metadata:

name: openshift-compliance

- complianceType: musthave

objectDefinition:

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: compliance-operator

namespace: openshift-compliance

spec:

channel: release-0.1

name: compliance-operator

source: redhat-operators

sourceNamespace: openshift-marketplace

- complianceType: musthave

objectDefinition:

apiVersion: operators.coreos.com/v1

kind: OperatorGroup

metadata:

name: compliance-operator

namespace: openshift-compliance

spec:

targetNamespaces:

- compliance-operator

remediationAction: enforce

severity: low如需了解更多详细信息,请参阅 Compliance Operator 文档。

2.4.2.4. 在 OpenShift GitOps (ArgoCD) 上安装策略生成器

基于 ArgoCD 的 OpenShift GitOps 也可用于通过 GitOps 使用策略生成器生成策略。由于 OpenShift GitOps 容器镜像中没有预安装策略生成器,因此需要进行一些自定义。为了继续操作,预计在 Red Hat Advanced Cluster Management hub 集群中安装了 OpenShift GitOps Operator,并确保登录到 hub 集群。

为了使 OpenShift GitOps 在运行 Kustomize 时可以访问策略生成器,需要初始容器将 Red Hat Advanced Cluster Management Application Subscription 容器镜像中的策略生成器二进制文件复制到 OpenShift GitOps 容器,该运行 Kustomize。如需了解更多详细信息,请参阅在部署 pod 前使用初始容器执行任务。另外,OpenShift GitOps 必须被配置为在运行 Kustomize 时提供 --enable-alpha-plugins 标志。使用以下命令开始编辑 OpenShift GitOps argocd 对象:

oc -n openshift-gitops edit argocd openshift-gitops

然后,修改 OpenShift GitOps argocd 对象使其包含以下额外的 YAML 内容。当发布新的 Red Hat Advanced Cluster Management 主版本且您要将策略生成器更新至更新的版本时,您需要更新 registry.redhat.io/rhacm2/multicluster-operators-subscription-rhel8 镜像,供 Init 容器用于较新的标签。查看以下示例,将 <version> 替换为 2.5 或所需的 Red Hat Advanced Cluster Management 版本:

apiVersion: argoproj.io/v1alpha1

kind: ArgoCD

metadata:

name: openshift-gitops

namespace: openshift-gitops

spec:

kustomizeBuildOptions: --enable-alpha-plugins

repo:

env:

- name: KUSTOMIZE_PLUGIN_HOME

value: /etc/kustomize/plugin

initContainers:

- args:

- -c

- cp /etc/kustomize/plugin/policy.open-cluster-management.io/v1/policygenerator/PolicyGenerator

/policy-generator/PolicyGenerator

command:

- /bin/bash

image: registry.redhat.io/rhacm2/multicluster-operators-subscription-rhel8:v<version>

name: policy-generator-install

volumeMounts:

- mountPath: /policy-generator

name: policy-generator

volumeMounts:

- mountPath: /etc/kustomize/plugin/policy.open-cluster-management.io/v1/policygenerator

name: policy-generator

volumes:

- emptyDir: {}

name: policy-generator

现在,OpenShift GitOps 可以使用策略生成器,OpenShift GitOps 必须被授予在 Red Hat Advanced Cluster Management hub 集群中创建策略的访问权限。创建以下 ClusterRole 资源,名为 openshift-gitops-policy-admin,它有权创建、读取、更新和删除策略和放置。您的 ClusterRole 可能类似以下示例:

kind: ClusterRole

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: openshift-gitops-policy-admin

rules:

- verbs:

- get

- list

- watch

- create

- update

- patch

- delete

apiGroups:

- policy.open-cluster-management.io

resources:

- policies

- placementbindings

- verbs:

- get

- list

- watch

- create

- update

- patch

- delete

apiGroups:

- apps.open-cluster-management.io

resources:

- placementrules

- verbs:

- get

- list

- watch

- create

- update

- patch

- delete

apiGroups:

- cluster.open-cluster-management.io

resources:

- placements

- placements/status

- placementdecisions

- placementdecisions/status

另外,创建一个 ClusterRoleBinding 对象来授予 OpenShift GitOps 服务帐户对 openshift-gitops-policy-admin ClusterRole 的访问权限。ClusterRoleBinding 可能类似以下资源:

kind: ClusterRoleBinding

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: openshift-gitops-policy-admin

subjects:

- kind: ServiceAccount

name: openshift-gitops-argocd-application-controller

namespace: openshift-gitops

roleRef:

apiGroup: rbac.authorization.k8s.io

kind: ClusterRole

name: openshift-gitops-policy-admin2.4.2.5. 策略生成器配置参考表

请注意,每个策略可覆盖 policyDefaults 部分中除 namespace 以外的所有字段。

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| complianceType |

可选。决定在将清单与集群上对象进行比较时的策略控制器行为。参数值为 |

| kind |

必需。将值设为 |

| metadata | 必需。用于唯一标识配置文件。 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| placementBindingDefaults |

必需。用于整合 |

| placementBindingDefaults.name | 可选。最佳实践是设置要使用的显式放置绑定名称,而不使用默认值。 |

| policyDefaults |

必需。对于 policies 数组中的条目,这里列出的任何默认值都会被覆盖,但 |

| policyDefaults.categories |

可选。 |

| policyDefaults.controls |

可选。 |

| policyDefaults.consolidateManifests |

可选。这决定了是否为策略中包含的所有清单生成单一配置策略。如果设置为 |

| policyDefaults.informGatekeeperPolicies |

可选。当策略引用违反 gatekeeper 策略清单时,这决定了是否应生成额外的配置策略以便在 Red Hat Advanced Cluster Management 中接收策略违反情况。默认值为 |

| policyDefaults.informKyvernoPolicies |

可选。当策略引用 Kyverno 策略清单时,这决定了在 Kyverno 策略被违反时,是否应生成额外的配置策略来接收 Red Hat Advanced Cluster Management 中的策略违反情况。默认值为 |

| policyDefaults.namespace | 必需。所有策略的命名空间。 |

| policyDefaults.placement | 可选。策略的放置配置。这默认为与所有集群匹配的放置配置。 |

| placement.clusterSelectors |

可选。通过以以下格式 |

| placement.name | 可选。指定一个名称来整合包含相同集群选择器的放置规则。 |

| placement.placementRulePath |

可选。要重复使用现有放置规则,请指定相对于 |

| policyDefaults.remediationAction |

可选。策略的补救机制。参数值是 |

| policyDefaults.severity |

可选。策略违反的严重性。默认值为 |

| policyDefaults.standards |

可选。 |

| policies |

必需。要创建的策略列表以及覆盖默认值或 |

| policies[ ].manifests | 必需。策略中包含的 Kubernetes 对象清单列表。 |

| policies[ ].name | 必需。要创建的策略的名称。 |

| policies[ ].manifests[ ].complianceType |

可选。决定在将清单与集群上对象进行比较时的策略控制器行为。参数值为 |

| policies[ ].manifests[ ].path |

必需。与 |

| policies[ ].manifests[ ].patches |

可选。应用到路径上清单的 Kustomize 补丁程序。如果有多个清单,补丁需要设置 |

2.5. 支持的策略

查看支持的策略示例,了解如何在 Red Hat Advanced Cluster Management for Kubernetes 中创建和管理策略时如何在 hub 集群上定义规则、流程和控制。

注:您可以将现有策略复制到 Policy YAML 中。当您粘贴现有策略时,会自动输入参数字段的值。您还可以使用搜索功能搜索策略 YAML 文件中的内容。

2.5.1. 开箱即用策略的支持列表

| 策略 | Red Hat OpenShift Container Platform 3.11 | Red Hat OpenShift Container Platform 4 |

|---|---|---|

| 内存用量策略 | x | x |

| 命名空间策略 | x | x |

| 镜像漏洞策略 | x | x |

| Pod 策略 | x | x |

| Pod 安全策略(已弃用) | ||

| 角色策略 | x | x |

| 角色绑定策略 | x | x |

| 安全性上下文约束策略(SCC) | x | x |

| ETCD 加密策略 | x | |

| Gatekeeper 策略 | x | |

| Compliance operator 策略 | x | |

| E8 扫描策略 | x | |

| OpenShift CIS 扫描策略 | x | |

| 策略设置 | x | |

| Kyverno 添加网络 | x | |

| Kyverno 添加配额 | x | |

| Kyverno 同步 secret | x |

查看以下策略示例以查看如何应用特定策略:

更多主题,请参阅监管。

2.5.2. 内存用量策略

Kubernetes 配置策略控制器负责监控内存用量策略的状态。使用内存用量策略来限制或约束您的内存和计算用量。如需更多信息,请参阅 Kubernetes 文档中的限制范围。

在以下部分了解更多有关内存用量策略结构的详细信息:

2.5.2.1. 内存用量策略 YAML 结构

您的内存用量策略可能类似以下 YAML 文件:

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

name: policy-limitrange

namespace:

spec:

complianceType:

remediationAction:

namespaces:

exclude:

include:

object-templates:

- complianceType:

objectDefinition:

apiVersion:

kind:

metadata:

name:

spec:

limits:

- default:

memory:

defaultRequest:

memory:

type:

...2.5.2.2. 内存用量策略表

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| metadata.namespaces | 可选。 |

| spec.namespace |

必需。策略应用到的节点集群内命名空间。输入 |

| remediationAction |

可选。指定您的策略的修复。参数值是 |

| disabled |

必需。将值设为 |

| spec.complianceType |

必需。将值设为 |

| spec.object-template | 可选。用于列出必须接受评估或应用到受管集群的任何其他 Kubernetes 对象。 |

2.5.2.3. 内存用量策略示例

请参阅 policy-limitmemory.yaml 查看策略示例。如需了解更多详细信息,请参阅管理安全策略。请参阅 Kubernetes 配置策略控制器以查看控制器监控的其他配置策略。

2.5.3. 命名空间策略

Kubernetes 配置策略控制器负责监控命名空间策略的状态。应用命名空间策略来为您的命名空间定义特定规则。

在以下部分了解更多有关命名空间策略结构的详细信息:

2.5.3.1. 命名空间策略 YAML 结构

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

name: policy-namespace-1

namespace:

spec:

complianceType:

remediationAction:

namespaces:

exclude:

include:

object-templates:

- complianceType:

objectDefinition:

kind:

apiVersion:

metadata:

name:

...2.5.3.2. 命名空间策略 YAML 表

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| metadata.namespaces | 可选。 |

| spec.namespace |

必需。策略应用到的节点集群内命名空间。输入 |

| remediationAction |

可选。指定您的策略的修复。参数值是 |

| disabled |

必需。将值设为 |

| spec.complianceType |

必需。将值设为 |

| spec.object-template | 可选。用于列出必须接受评估或应用到受管集群的任何其他 Kubernetes 对象。 |

2.5.3.3. 命名空间策略示例

请参阅 policy-namespace.yaml 查看策略示例。

如需了解更多详细信息,请参阅管理安全策略。请参阅 Kubernetes 配置策略控制器以了解其他配置策略。

2.5.4. 镜像漏洞策略

应用镜像漏洞策略,以利用 Container Security Operator 来检测容器镜像是否有漏洞。如果没有安装 Container Security Operator,该策略会在受管集群上安装它。

镜像漏洞策略由 Kubernetes 配置策略控制器负责检查。有关 Security Operator 的更多信息,请参阅 Quay 存储库中的 Container Security Operator。

备注:

- 镜像漏洞策略在断开连接的安装过程中无法正常工作。

-

IBM Power 和 IBM Z 架构不支持 镜像漏洞策略。它依赖于 Quay Container Security Operator。container-security-operator registry 中没有

ppc64le或s390x镜像。

查看以下部分以了解更多信息:

2.5.4.1. 镜像漏洞策略 YAML 结构

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

name: policy-imagemanifestvulnpolicy

namespace: default

annotations:

policy.open-cluster-management.io/standards: NIST-CSF

policy.open-cluster-management.io/categories: DE.CM Security Continuous Monitoring

policy.open-cluster-management.io/controls: DE.CM-8 Vulnerability Scans

spec:

remediationAction:

disabled:

policy-templates:

- objectDefinition:

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name:

spec:

remediationAction:

severity: high

object-templates:

- complianceType:

objectDefinition:

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: container-security-operator

namespace:

spec:

channel:

installPlanApproval:

name:

source:

sourceNamespace:

- objectDefinition:

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name:

spec:

remediationAction:

severity:

namespaceSelector:

exclude:

include:

object-templates:

- complianceType:

objectDefinition:

apiVersion: secscan.quay.redhat.com/v1alpha1

kind: ImageManifestVuln # checking for a kind

---

apiVersion: policy.open-cluster-management.io/v1

kind: PlacementBinding

metadata:

name: binding-policy-imagemanifestvulnpolicy

namespace: default

placementRef:

name:

kind:

apiGroup:

subjects:

- name:

kind:

apiGroup:

---

apiVersion: apps.open-cluster-management.io/v1

kind: PlacementRule

metadata:

name: placement-policy-imagemanifestvulnpolicy

namespace: default

spec:

clusterConditions:

- status:

type:

clusterSelector:

matchExpressions:

[] # selects all clusters if not specified2.5.4.2. 镜像漏洞策略 YAML 表

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| metadata.namespaces | 可选。 |

| spec.namespace |

必需。策略应用到的节点集群内命名空间。输入 |

| remediationAction |

可选。指定您的策略的修复。参数值是 |

| disabled |

必需。将值设为 |

| spec.complianceType |

必需。将值设为 |

| spec.object-template | 可选。用于列出必须接受评估或应用到受管集群的任何其他 Kubernetes 对象。 |

2.5.4.3. 镜像漏洞策略示例

请参阅 policy-imagemanifestvuln.yaml。如需更多信息,请参阅管理安全策略。

请参阅 Kubernetes 配置策略控制器,以查看配置控制器监控的其他配置策略。

2.5.5. Pod 策略

Kubernetes 配置策略控制器负责监控 Pod 策略的状态。应用 Pod 策略来为 Pod 定义容器规则。集群中必须存在 pod 才能使用此信息。

在以下部分了解更多有关 pod 策略结构的详细信息:

2.5.5.1. Pod 策略 YAML 结构

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

name: policy-pod

namespace:

spec:

complianceType:

remediationAction:

namespaces:

exclude:

include:

object-templates:

- complianceType:

objectDefinition:

apiVersion:

kind: Pod # pod must exist

metadata:

name:

spec:

containers:

- image:

name:

ports:

- containerPort:

...2.5.5.2. Pod 策略表

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| metadata.namespaces | 可选。 |

| spec.namespace |

必需。策略应用到的节点集群内命名空间。输入 |

| remediationAction |

可选。指定您的策略的修复。参数值是 |

| disabled |

必需。将值设为 |

| spec.complianceType |

必需。将值设为 |

| spec.object-template | 可选。用于列出必须接受评估或应用到受管集群的任何其他 Kubernetes 对象。 |

2.5.5.3. Pod 策略示例

请参阅 policy-pod.yaml 查看策略示例。

请参阅 Kubernetes 配置策略控制器,以查看配置控制器监控的其他配置策略。请参阅管理配置策略以管理其他策略。

2.5.6. Pod 安全策略

Kubernetes 配置策略控制器负责监控 Pod 安全策略的状态。应用 Pod 安全策略来保护 Pod 和容器。如需更多信息,请参阅 Kubernetes 文档中的 Pod 安全策略。

在以下部分了解更多有关 Pod 安全策略结构的详细信息:

2.5.6.1. Pod 安全策略 YAML 结构

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

name: policy-podsecuritypolicy

namespace:

spec:

complianceType:

remediationAction:

namespaces:

exclude:

include:

object-templates:

- complianceType:

objectDefinition:

apiVersion:

kind: PodSecurityPolicy # no privileged pods

metadata:

name:

annotations:

spec:

privileged:

allowPrivilegeEscalation:

allowedCapabilities:

volumes:

hostNetwork:

hostPorts:

hostIPC:

hostPID:

runAsUser:

rule:

seLinux:

rule:

supplementalGroups:

rule:

fsGroup:

rule:

...2.5.6.2. Pod 安全策略表

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| metadata.namespaces | 可选。 |

| spec.namespace |

必需。策略应用到的节点集群内命名空间。输入 |

| remediationAction |

可选。指定您的策略的修复。参数值是 |

| disabled |

必需。将值设为 |

| spec.complianceType |

必需。将值设为 |

| spec.object-template | 可选。用于列出必须接受评估或应用到受管集群的任何其他 Kubernetes 对象。 |

2.5.6.3. Pod 安全策略示例

请参阅 policy-psp.yaml 查看示例策略。如需更多信息,请参阅管理配置策略。

请参阅 Kubernetes 配置策略控制器以查看控制器监控的其他配置策略。

2.5.7. 角色策略

Kubernetes 配置策略控制器负责监控角色策略的状态。在 object-template 中定义角色来为集群中的特定角色设置规则和权限。

在以下部分了解更多有关角色策略结构的详细信息:

2.5.7.1. 角色策略 YAML 结构

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

name: policy-role

namespace:

annotations:

policy.open-cluster-management.io/standards: NIST-CSF

policy.open-cluster-management.io/categories: PR.AC Identity Management Authentication and Access Control

policy.open-cluster-management.io/controls: PR.AC-4 Access Control

spec:

remediationAction: inform

disabled: false

policy-templates:

- objectDefinition:

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name: policy-role-example

spec:

remediationAction: inform # will be overridden by remediationAction in parent policy

severity: high

namespaceSelector:

include: ["default"]

object-templates:

- complianceType: mustonlyhave # role definition should exact match

objectDefinition:

apiVersion: rbac.authorization.k8s.io/v1

kind: Role

metadata:

name: sample-role

rules:

- apiGroups: ["extensions", "apps"]

resources: ["deployments"]

verbs: ["get", "list", "watch", "delete","patch"]

---

apiVersion: policy.open-cluster-management.io/v1

kind: PlacementBinding

metadata:

name: binding-policy-role

namespace:

placementRef:

name: placement-policy-role

kind: PlacementRule

apiGroup: apps.open-cluster-management.io

subjects:

- name: policy-role

kind: Policy

apiGroup: policy.open-cluster-management.io

---

apiVersion: apps.open-cluster-management.io/v1

kind: PlacementRule

metadata:

name: placement-policy-role

namespace:

spec:

clusterConditions:

- type: ManagedClusterConditionAvailable

status: "True"

clusterSelector:

matchExpressions:

[]

...2.5.7.2. 角色策略表

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| metadata.namespaces | 可选。 |

| spec.namespace |

必需。策略应用到的节点集群内命名空间。输入 |

| remediationAction |

可选。指定您的策略的修复。参数值是 |

| disabled |

必需。将值设为 |

| spec.complianceType |

必需。将值设为 |

| spec.object-template | 可选。用于列出必须接受评估或应用到受管集群的任何其他 Kubernetes 对象。 |

2.5.7.3. 角色策略示例

应用角色策略来为集群中的特定角色设置规则和权限。如需有关角色的更多信息,请参阅基于角色的访问控制。查看角色策略示例,请参阅 policy-role.yaml。

要了解如何管理角色策略,请参阅管理配置策略以了解更多信息。请参阅 Kubernetes 配置策略控制器,以查看监控控制器的其他配置策略。

2.5.8. 角色绑定策略

Kubernetes 配置策略控制器负责监控角色绑定策略的状态。应用角色绑定策略,将策略绑定到受管集群中的命名空间。

在以下部分了解更多有关命名空间策略结构的详细信息:

2.5.8.1. 角色绑定策略 YAML 结构

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

name:

namespace:

spec:

complianceType:

remediationAction:

namespaces:

exclude:

include:

object-templates:

- complianceType:

objectDefinition:

kind: RoleBinding # role binding must exist

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: operate-pods-rolebinding

subjects:

- kind: User

name: admin # Name is case sensitive

apiGroup:

roleRef:

kind: Role #this must be Role or ClusterRole

name: operator # this must match the name of the Role or ClusterRole you wish to bind to

apiGroup: rbac.authorization.k8s.io

...2.5.8.2. 角色绑定策略表

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| metadata.namespaces | 必需。创建了策略的受管集群内命名空间。 |

| spec | 必需。有关如何标识和修复合规违反情况的规格。 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| metadata.namespaces | 可选。 |

| spec.complianceType |

必需。将值设为 |

| spec.namespace |

必需。要将策略应用到的受管集群命名空间。输入 |

| spec.remediationAction |

必需。指定您的策略的修复。参数值是 |

| spec.object-template | 必需。用于列出必须接受评估或应用到受管集群的任何其他 Kubernetes 对象。 |

2.5.8.3. 角色绑定策略示例

请参阅 policy-rolebinding.yaml 查看策略示例。有关管理其他策略的更多信息,请参阅管理配置策略。

请参阅 Kubernetes 配置策略控制器以了解其他配置策略。

2.5.9. 安全性上下文约束策略

Kubernetes 配置策略控制器负责监控安全性上下文约束 (SCC) 策略的状态。应用安全性上下文约束 (SCC) 策略,通过在策略中定义条件来控制 Pod 的权限。

在以下部分了解更多有关 SCC 策略的详细信息:

2.5.9.1. SCC 策略 YAML 结构

apiVersion: policy.open-cluster-management.io/v1

kind: Policy

metadata:

name: policy-scc

namespace: open-cluster-management-policies

spec:

complianceType:

remediationAction:

namespaces:

exclude:

include:

object-templates:

- complianceType:

objectDefinition:

apiVersion:

kind: SecurityContextConstraints # restricted scc

metadata:

annotations:

kubernetes.io/description:

name: sample-restricted-scc

allowHostDirVolumePlugin:

allowHostIPC:

allowHostNetwork:

allowHostPID:

allowHostPorts:

allowPrivilegeEscalation:

allowPrivilegedContainer:

allowedCapabilities:

defaultAddCapabilities:

fsGroup:

type:

groups:

- system:

priority:

readOnlyRootFilesystem:

requiredDropCapabilities:

runAsUser:

type:

seLinuxContext:

type:

supplementalGroups:

type:

users:

volumes:2.5.9.2. SCC 策略表

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| metadata.namespace | 必需。创建了策略的受管集群内命名空间。 |

| spec.complianceType |

必需。将值设为 |

| spec.remediationAction |

必需。指定您的策略的修复。参数值是 |

| spec.namespace |

必需。要将策略应用到的受管集群命名空间。输入 |

| spec.object-template | 必需。用于列出必须接受评估或应用到受管集群的任何其他 Kubernetes 对象。 |

有关 SCC 策略内容的解释,请参阅 OpenShift Container Platform 文档中的管理安全性上下文约束。

2.5.9.3. SCC 策略示例

应用安全性上下文约束 (SCC) 策略,通过在策略中定义条件来控制 Pod 的权限。如需更多信息,请参阅管理安全性上下文约束(SCC)。

请参阅 policy-scc.yaml 查看策略示例。有关管理其他策略的更多信息,请参阅管理配置策略。

请参阅 Kubernetes 配置策略控制器以了解其他配置策略。

2.5.10. ETCD 加密策略

应用 etcd-encryption 策略,在 ETCD 数据存储中检测或启用敏感数据的加密。Kubernetes 配置策略控制器负责监控 etcd-encryption 策略的状态。如需更多信息,请参阅 OpenShift Container Platform 文档中的加密 etcd 数据。注 :ETCD 加密策略只支持 Red Hat OpenShift Container Platform 4 及更新的版本。

在以下部分了解更多有关 etcd-encryption 策略结构的详细信息:

2.5.10.1. ETCD 加密策略 YAML 结构

etcd-encryption 策略可能类似以下 YAML 文件:

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name: policy-etcdencryption

namespace:

spec:

complianceType:

remediationAction:

namespaces:

exclude:

include:

object-templates:

- complianceType:

objectDefinition:

apiVersion: config.openshift.io/v1

kind: APIServer

metadata:

name: cluster

spec:

encryption:

type:

...2.5.10.2. ETCD 加密策略表

| 字段 | 描述 |

|---|---|

| apiVersion |

必需。将值设置为 |

| kind |

必需。将值设为 |

| metadata.name | 必需。用于标识策略资源的名称。 |

| metadata.namespaces | 可选。 |

| spec.namespace |

必需。策略应用到的节点集群内命名空间。输入 |

| remediationAction |

可选。指定您的策略的修复。参数值是 |

| disabled |

必需。将值设为 |

| spec.complianceType |

必需。将值设为 |

| spec.object-template | 可选。用于列出必须接受评估或应用到受管集群的任何其他 Kubernetes 对象。请参阅 OpenShift Container Platform 文档中的加密 etcd 数据。 |

2.5.10.3. etcd 加密策略示例

如需策略示例,请参阅 policy-etcdencryption.yaml。如需更多信息,请参阅管理安全策略。

请参阅 Kubernetes 配置策略控制器以查看控制器监控的其他配置策略。

2.5.11. Compliance operator 策略

Compliance Operator 是一个运行 OpenSCAP 的 operator,可让您使 Red Hat OpenShift Container Platform 集群与您需要的安全基准兼容。您可以使用合规 operator 策略在受管集群上安装合规 Operator。

compliance operator 策略在 Red Hat Advanced Cluster Management 中作为 Kubernetes 配置策略创建。OpenShift Container Platform 4.6 和 4.7 支持合规性 Operator 策略。如需更多信息,请参阅 OpenShift Container Platform 文档中的 了解 Compliance Operator 部分以了解更多详细信息。

注: Compliance operator 策略依赖于 OpenShift Container Platform Compliance Operator,它不受 IBM Power 或 IBM Z 架构的支持。如需有关 Compliance Operator 的更多信息,请参阅 OpenShift Container Platform 文档中的了解 Compliance Operator。

2.5.11.1. Compliance operator 资源

创建合规 Operator 策略时,会创建以下资源:

-

Operator 安装的合规性 operator 命名空间(

openshift- compliance):

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name: comp-operator-ns

spec:

remediationAction: inform # will be overridden by remediationAction in parent policy

severity: high

object-templates:

- complianceType: musthave

objectDefinition:

apiVersion: v1

kind: Namespace

metadata:

name: openshift-compliance-

用于指定目标命名空间的 operator 组(

compliance-operator):

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name: comp-operator-operator-group

spec:

remediationAction: inform # will be overridden by remediationAction in parent policy

severity: high

object-templates:

- complianceType: musthave

objectDefinition:

apiVersion: operators.coreos.com/v1

kind: OperatorGroup

metadata:

name: compliance-operator

namespace: openshift-compliance

spec:

targetNamespaces:

- openshift-compliance-

用于引用名称和频道的订阅(

comp-operator-subscription)。订阅会拉取配置集作为一个容器,它支持:

apiVersion: policy.open-cluster-management.io/v1

kind: ConfigurationPolicy

metadata:

name: comp-operator-subscription

spec:

remediationAction: inform # will be overridden by remediationAction in parent policy

severity: high

object-templates:

- complianceType: musthave

objectDefinition:

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: compliance-operator

namespace: openshift-compliance

spec:

channel: "4.7"

installPlanApproval: Automatic

name: compliance-operator

source: redhat-operators

sourceNamespace: openshift-marketplace

安装 compliance operator 策略后,会创建以下 pod:compliance-operator、ocp4 和 rhcos4。请参阅 policy-compliance-operator-install.yaml 示例。

安装 compliance Operator 后,您还可以创建并应用 E8 扫描策略和 OpenShift CIS 扫描策略。如需更多信息,请参阅 E8 扫描策略和 OpenShift CIS 扫描策略。

要了解如何管理合规 Operator 策略,请参阅管理安全策略以了解更多详细信息。有关配置策略的更多主题,请参阅 Kubernetes 配置策略控制器。

2.5.12. E8 扫描策略

一个 Essential 8(E8)扫描策略会部署一个扫描,检查 master 和 worker 节点是否满足 E8 安全配置集。您必须安装 Compliance Operator 以应用 E8 扫描策略。

E8 扫描策略在 Red Hat Advanced Cluster Management 中作为 Kubernetes 配置策略创建。OpenShift Container Platform 4.7 和 4.6 支持 E8 扫描策略。如需更多信息,请参阅 OpenShift Container Platform 文档中的 了解 Compliance Operator 部分以了解更多详细信息。

2.5.12.1. E8 扫描策略资源

当您创建 E8 扫描策略时,会创建以下资源:

ScanSettingBinding资源 (e8) 用于识别要扫描的配置集:apiVersion: policy.open-cluster-management.io/v1 kind: ConfigurationPolicy metadata: name: compliance-suite-e8 spec: remediationAction: inform severity: high object-templates: - complianceType: musthave # this template checks if scan has completed by checking the status field objectDefinition: apiVersion: compliance.openshift.io/v1alpha1 kind: ScanSettingBinding metadata: name: e8 namespace: openshift-compliance profiles: - apiGroup: compliance.openshift.io/v1alpha1 kind: Profile name: ocp4-e8 - apiGroup: compliance.openshift.io/v1alpha1 kind: Profile name: rhcos4-e8 settingsRef: apiGroup: compliance.openshift.io/v1alpha1 kind: ScanSetting name: default一个

ComplianceSuite资源 (compliance-suite-e8),用于通过检查status字段来验证扫描是否已完成:apiVersion: policy.open-cluster-management.io/v1 kind: ConfigurationPolicy metadata: name: compliance-suite-e8 spec: remediationAction: inform severity: high object-templates: - complianceType: musthave # this template checks if scan has completed by checking the status field objectDefinition: apiVersion: compliance.openshift.io/v1alpha1 kind: ComplianceSuite metadata: name: e8 namespace: openshift-compliance status: phase: DONE一个

ComplianceCheckResult资源 (compliance-suite-e8-results),它通过检查ComplianceCheckResult自定义资源 (CR) 来报告扫描套件的结果:apiVersion: policy.open-cluster-management.io/v1 kind: ConfigurationPolicy metadata: name: compliance-suite-e8-results spec: remediationAction: inform severity: high object-templates: - complianceType: mustnothave # this template reports the results for scan suite: e8 by looking at ComplianceCheckResult CRs objectDefinition: apiVersion: compliance.openshift.io/v1alpha1 kind: ComplianceCheckResult metadata: namespace: openshift-compliance labels: compliance.openshift.io/check-status: FAIL compliance.openshift.io/suite: e8

注: 支持自动补救。将补救操作设置为 enforce 以创建 ScanSettingBinding 资源。

请参阅 policy-compliance-operator-e8-scan.yaml 示例。如需更多信息,请参阅管理安全策略。注 : 删除 E8 策略后,它会从目标集群或集群中删除。

2.5.13. OpenShift CIS 扫描策略

OpenShift CIS 扫描策略会部署一个扫描来检查 master 和 worker 节点是否与 OpenShift CIS 安全基准相符。您必须安装 Compliance operator 以应用 OpenShift CIS 策略。

OpenShift CIS 扫描策略在 Red Hat Advanced Cluster Management 中作为 Kubernetes 配置策略创建。OpenShift Container Platform 4.9、4.7 和 4.6 支持 OpenShift CIS 扫描策略。如需更多信息,请参阅 OpenShift Container Platform 文档中的 了解 Compliance Operator 部分以了解更多详细信息。

2.5.13.1. OpenShift CIS 资源

创建 OpenShift CIS 扫描策略时,会创建以下资源:

用于识别要扫描的配置集的

ScanSettingBinding资源 (cis):apiVersion: policy.open-cluster-management.io/v1 kind: ConfigurationPolicy metadata: name: compliance-cis-scan spec: remediationAction: inform severity: high object-templates: - complianceType: musthave # this template creates ScanSettingBinding:cis objectDefinition: apiVersion: compliance.openshift.io/v1alpha1 kind: ScanSettingBinding metadata: name: cis namespace: openshift-compliance profiles: - apiGroup: compliance.openshift.io/v1alpha1 kind: Profile name: ocp4-cis - apiGroup: compliance.openshift.io/v1alpha1 kind: Profile name: ocp4-cis-node settingsRef: apiGroup: compliance.openshift.io/v1alpha1 kind: ScanSetting name: default一个

ComplianceSuite资源 (compliance-suite-cis),用于通过检查status字段来验证扫描是否已完成:apiVersion: policy.open-cluster-management.io/v1 kind: ConfigurationPolicy metadata: name: compliance-suite-cis spec: remediationAction: inform severity: high object-templates: - complianceType: musthave # this template checks if scan has completed by checking the status field objectDefinition: apiVersion: compliance.openshift.io/v1alpha1 kind: ComplianceSuite metadata: name: cis namespace: openshift-compliance status: phase: DONE一个

ComplianceCheckResult资源 (compliance-suite-cis-results),它通过检查ComplianceCheckResult自定义资源 (CR) 来报告扫描套件的结果:apiVersion: policy.open-cluster-management.io/v1 kind: ConfigurationPolicy metadata: name: compliance-suite-cis-results spec: remediationAction: inform severity: high object-templates: - complianceType: mustnothave # this template reports the results for scan suite: cis by looking at ComplianceCheckResult CRs objectDefinition: apiVersion: compliance.openshift.io/v1alpha1 kind: ComplianceCheckResult metadata: namespace: openshift-compliance labels: compliance.openshift.io/check-status: FAIL compliance.openshift.io/suite: cis

请参阅 policy-compliance-operator-cis-scan.yaml 文件示例。有关创建策略的更多信息,请参阅管理安全策略。

2.5.14. Kyverno 添加网络策略

Kyverno 添加网络策略配置一个名为 default-deny 的新 NetworkPolicy 资源,它拒绝您在创建新命名空间时的所有流量。您必须安装 Kyverno 控制器才能使用 Kyverno 策略。有关安装策略,请参阅 policy-install-kyverno.yaml。

在以下部分了解更多有关 policy-kyverno-add-network-policy 策略结构的详细信息:

2.5.14.1. Kyverno 添加网络策略 YAML 结构

您的 policy-kyverno-add-network-policy 策略可能类似以下 YAML 文件:

apiVersion: kyverno.io/v1

kind: ClusterPolicy

metadata:

name: add-networkpolicy

annotations:

policies.kyverno.io/title: Add Network Policy

policies.kyverno.io/category: Multi-Tenancy

policies.kyverno.io/subject: NetworkPolicy

policies.kyverno.io/description: >-

By default, Kubernetes allows communications across all Pods within a cluster.

The NetworkPolicy resource and a CNI plug-in that supports NetworkPolicy must be used to restrict

communications. A default NetworkPolicy should be configured for each Namespace to

default deny all ingress and egress traffic to the Pods in the Namespace. Application

teams can then configure additional NetworkPolicy resources to allow desired traffic

to application Pods from select sources. This policy will create a new NetworkPolicy resource

named `default-deny` which will deny all traffic anytime a new Namespace is created.

spec:

rules:

- name: default-deny

match:

resources:

kinds:

- Namespace

generate:

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

name: default-deny

namespace: "{{request.object.metadata.name}}"

synchronize: true

data:

spec:

# select all pods in the namespace

podSelector: {}

# deny all traffic

policyTypes:

- Ingress

- Egress2.5.14.2. Kyverno 添加网络策略示例

如需策略示例,请参阅 policy-kyverno-add-network-policy.yaml。请参阅策略概述文档 和 Kubernetes 配置策略控制器,以查看策略和配置策略字段的更多详情。