高度なネットワーキング

OpenShift Container Platform の専門的かつ高度なネットワーキングトピック

概要

第1章 エンドポイントへの接続の確認

Cluster Network Operator (CNO) は、クラスター内のリソース間の接続ヘルスチェックを実行するコントローラーである接続性チェックコントローラーを実行します。ヘルスチェックの結果を確認して、調査している問題が原因で生じる接続の問題を診断したり、ネットワーク接続を削除したりできます。

1.1. 実行される接続ヘルスチェック

クラスターリソースにアクセスできることを確認するために、次の各クラスター API サービスへの TCP 接続が確立されます。

- Kubernetes API サーバーサービス

- Kubernetes API サーバーエンドポイント

- OpenShift API サーバーサービス

- OpenShift API サーバーエンドポイント

- ロードバランサー

サービスおよびサービスエンドポイントがクラスター内のすべてのノードで到達可能であることを確認するには、以下の各ターゲットに対して TCP 接続が行われます。

- ヘルスチェックターゲットサービス

- ヘルスチェックターゲットエンドポイント

1.2. 接続ヘルスチェックの実装

接続チェックコントローラーは、クラスター内の接続検証チェックをオーケストレーションします。接続テストの結果は、openshift-network-diagnostics namespace の PodNetworkConnectivity オブジェクトに保存されます。接続テストは、1 分ごとに並行して実行されます。

Cluster Network Operator (CNO) は、接続性ヘルスチェックを送受信するためにいくつかのリソースをクラスターにデプロイします。

- ヘルスチェックのソース

-

このプログラムは、

Deploymentオブジェクトで管理される単一の Pod レプリカセットにデプロイします。このプログラムはPodNetworkConnectivityオブジェクトを消費し、各オブジェクトで指定されるspec.targetEndpointに接続されます。 - ヘルスチェックのターゲット

- クラスターのすべてのノードにデーモンセットの一部としてデプロイされた Pod。Pod はインバウンドのヘルスチェックをリッスンします。すべてのノードにこの Pod が存在すると、各ノードへの接続をテストすることができます。

ノードセレクターを使用して、ネットワーク接続ソースとターゲットが実行されるノードを設定できます。さらに、ソース Pod とターゲット Pod で許容できる tolerations を指定することもできます。この設定は、config.openshift.io/v1 API グループの Network API のシングルトン cluster カスタムリソースで定義されます。

Pod のスケジュールは、設定を更新した後に実行されます。したがって、設定を更新する前に、セレクターで使用する予定のノードラベルを適用する必要があります。ネットワーク接続チェック Pod の配置を更新した後に適用されたラベルは無視されます。

次の YAML のデフォルト設定を参照してください。

接続ソースおよびターゲット Pod のデフォルト設定

apiVersion: config.openshift.io/v1

kind: Network

metadata:

name: cluster

spec:

# ...

networkDiagnostics:

mode: "All"

sourcePlacement:

nodeSelector:

checkNodes: groupA

tolerations:

- key: myTaint

effect: NoSchedule

operator: Exists

targetPlacement:

nodeSelector:

checkNodes: groupB

tolerations:

- key: myOtherTaint

effect: NoExecute

operator: Exists- 1

- ネットワーク診断設定を指定します。値が指定されていないか、空のオブジェクトが指定されており、

clusterという名前のnetwork.operator.openshift.ioカスタムリソースでspec.disableNetworkDiagnostics=trueが設定されている場合、ネットワーク診断は無効になります。設定されている場合、この値はspec.disableNetworkDiagnostics=trueをオーバーライドします。 - 2

- 診断モードを指定します。値は、空の文字列、

All、またはDisabledです。空の文字列はAllを指定するのと同じです。 - 3

- オプション: 接続チェックのソース Pod のセレクターを指定します。

nodeSelectorおよびtolerationsフィールドを使用して、sourceNodePod をさらに指定できます。これは、ソース Pod とターゲット Pod の両方でオプションです。省略することも、両方使用することも、いずれか一方だけ使用することもできます。 - 4

- オプション: 接続チェックのターゲット Pod のセレクターを指定します。

nodeSelectorおよびtolerationsフィールドを使用して、targetNodePod をさらに指定できます。これは、ソース Pod とターゲット Pod の両方でオプションです。省略することも、両方使用することも、いずれか一方だけ使用することもできます。

1.3. Pod 接続チェックの配置の設定

クラスター管理者は、cluster という名前の network.config.openshift.io オブジェクトを変更することで、接続チェック Pod が実行するノードを設定できます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。

手順

次のコマンドを入力して、接続チェックの設定を編集します。

$ oc edit network.config.openshift.io cluster-

テキストエディターで、

networkDiagnosticsスタンザを更新して、ソース Pod とターゲット Pod に必要なノードセレクターを指定します。 - 変更を保存してテキストエディターを終了します。

検証

- 次のコマンドを入力して、ソース Pod とターゲット Pod が目的のノードで実行されていることを検証します。

$ oc get pods -n openshift-network-diagnostics -o wide出力例

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

network-check-source-84c69dbd6b-p8f7n 1/1 Running 0 9h 10.131.0.8 ip-10-0-40-197.us-east-2.compute.internal <none> <none>

network-check-target-46pct 1/1 Running 0 9h 10.131.0.6 ip-10-0-40-197.us-east-2.compute.internal <none> <none>

network-check-target-8kwgf 1/1 Running 0 9h 10.128.2.4 ip-10-0-95-74.us-east-2.compute.internal <none> <none>

network-check-target-jc6n7 1/1 Running 0 9h 10.129.2.4 ip-10-0-21-151.us-east-2.compute.internal <none> <none>

network-check-target-lvwnn 1/1 Running 0 9h 10.128.0.7 ip-10-0-17-129.us-east-2.compute.internal <none> <none>

network-check-target-nslvj 1/1 Running 0 9h 10.130.0.7 ip-10-0-89-148.us-east-2.compute.internal <none> <none>

network-check-target-z2sfx 1/1 Running 0 9h 10.129.0.4 ip-10-0-60-253.us-east-2.compute.internal <none> <none>1.4. PodNetworkConnectivityCheck オブジェクトフィールド

PodNetworkConnectivityCheck オブジェクトフィールドは、以下の表で説明されています。

| フィールド | 型 | 説明 |

|---|---|---|

|

|

|

以下の形式のオブジェクトの名前:

|

|

|

|

オブジェクトが関連付けられる namespace。この値は、常に |

|

|

|

接続チェックの起点となる Pod の名前 (例: |

|

|

|

|

|

|

| 使用する TLS 証明書の設定。 |

|

|

| 使用される TLS 証明書の名前 (ある場合)。デフォルト値は空の文字列です。 |

|

|

| 接続テストの状態を表す、および最近の接続の成功および失敗に関するログ。 |

|

|

| 接続チェックと最新のステータスと以前のステータス。 |

|

|

| 試行に失敗した接続テストのログ。 |

|

|

| 停止が生じた期間が含まれる接続テストのログ。 |

|

|

| 試行に成功した接続テストのログ。 |

以下の表は、status.conditions 配列内のオブジェクトのフィールドを説明しています。

| フィールド | 型 | 説明 |

|---|---|---|

|

|

| 接続の条件がある状態から別の状態に移行した時間。 |

|

|

| 人が判読できる形式の最後の移行に関する詳細。 |

|

|

| マシンの読み取り可能な形式での移行の最後のステータス。 |

|

|

| 状態のテータス。 |

|

|

| 状態のタイプ。 |

以下の表は、status.conditions 配列内のオブジェクトのフィールドを説明しています。

| フィールド | 型 | 説明 |

|---|---|---|

|

|

| 接続の障害が解決された時点からのタイムスタンプ。 |

|

|

| 接続ログエントリー (停止の正常な終了に関連するログエントリーを含む)。 |

|

|

| 人が判読できる形式の停止に関する詳細情報の要約。 |

|

|

| 接続の障害が最初に検知された時点からのタイムスタンプ。 |

|

|

| 元の障害を含む接続ログのエントリー。 |

1.4.1. 接続ログフィールド

接続ログエントリーのフィールドの説明は以下の表で説明されています。オブジェクトは以下のフィールドで使用されます。

-

status.failures[] -

status.successes[] -

status.outages[].startLogs[] -

status.outages[].endLogs[]

| フィールド | 型 | 説明 |

|---|---|---|

|

|

| アクションの期間を記録します。 |

|

|

| ステータスを人が判読できる形式で提供します。 |

|

|

|

ステータスの理由をマシンが判読できる形式で提供します。値は |

|

|

| ログエントリーが成功または失敗であるかを示します。 |

|

|

| 接続チェックの開始時間。 |

1.5. エンドポイントのネットワーク接続の確認

クラスター管理者は、API サーバー、ロードバランサー、サービス、Pod などのエンドポイントの接続を確認し、ネットワーク診断が有効になっていることを確認できます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-adminロールを持つユーザーとしてクラスターにアクセスできる。

手順

次のコマンドを入力して、ネットワーク診断が有効になっていることを確認します。

$ oc get network.config.openshift.io cluster -o yaml出力例

# ... status: # ... conditions: - lastTransitionTime: "2024-05-27T08:28:39Z" message: "" reason: AsExpected status: "True" type: NetworkDiagnosticsAvailable次のコマンドを入力して、現在の

PodNetworkConnectivityCheckオブジェクトをリスト表示します。$ oc get podnetworkconnectivitycheck -n openshift-network-diagnostics出力例

NAME AGE network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-1 73m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-2 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-kubernetes-apiserver-service-cluster 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-kubernetes-default-service-cluster 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-load-balancer-api-external 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-load-balancer-api-internal 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-network-check-target-ci-ln-x5sv9rb-f76d1-4rzrp-master-0 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-network-check-target-ci-ln-x5sv9rb-f76d1-4rzrp-master-1 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-network-check-target-ci-ln-x5sv9rb-f76d1-4rzrp-master-2 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-network-check-target-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh 74m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-network-check-target-ci-ln-x5sv9rb-f76d1-4rzrp-worker-c-n8mbf 74m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-network-check-target-ci-ln-x5sv9rb-f76d1-4rzrp-worker-d-4hnrz 74m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-network-check-target-service-cluster 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-openshift-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-openshift-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-1 75m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-openshift-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-2 74m network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-openshift-apiserver-service-cluster 75m接続テストログを表示します。

- 直前のコマンドの出力から、接続ログを確認するエンドポイントを特定します。

次のコマンドを入力してオブジェクトを表示します。

$ oc get podnetworkconnectivitycheck <name> \ -n openshift-network-diagnostics -o yamlここで、

<name>はPodNetworkConnectivityCheckオブジェクトの名前を指定します。出力例

apiVersion: controlplane.operator.openshift.io/v1alpha1 kind: PodNetworkConnectivityCheck metadata: name: network-check-source-ci-ln-x5sv9rb-f76d1-4rzrp-worker-b-6xdmh-to-kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0 namespace: openshift-network-diagnostics ... spec: sourcePod: network-check-source-7c88f6d9f-hmg2f targetEndpoint: 10.0.0.4:6443 tlsClientCert: name: "" status: conditions: - lastTransitionTime: "2021-01-13T20:11:34Z" message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnectSuccess status: "True" type: Reachable failures: - latency: 2.241775ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: failed to establish a TCP connection to 10.0.0.4:6443: dial tcp 10.0.0.4:6443: connect: connection refused' reason: TCPConnectError success: false time: "2021-01-13T20:10:34Z" - latency: 2.582129ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: failed to establish a TCP connection to 10.0.0.4:6443: dial tcp 10.0.0.4:6443: connect: connection refused' reason: TCPConnectError success: false time: "2021-01-13T20:09:34Z" - latency: 3.483578ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: failed to establish a TCP connection to 10.0.0.4:6443: dial tcp 10.0.0.4:6443: connect: connection refused' reason: TCPConnectError success: false time: "2021-01-13T20:08:34Z" outages: - end: "2021-01-13T20:11:34Z" endLogs: - latency: 2.032018ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnect success: true time: "2021-01-13T20:11:34Z" - latency: 2.241775ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: failed to establish a TCP connection to 10.0.0.4:6443: dial tcp 10.0.0.4:6443: connect: connection refused' reason: TCPConnectError success: false time: "2021-01-13T20:10:34Z" - latency: 2.582129ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: failed to establish a TCP connection to 10.0.0.4:6443: dial tcp 10.0.0.4:6443: connect: connection refused' reason: TCPConnectError success: false time: "2021-01-13T20:09:34Z" - latency: 3.483578ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: failed to establish a TCP connection to 10.0.0.4:6443: dial tcp 10.0.0.4:6443: connect: connection refused' reason: TCPConnectError success: false time: "2021-01-13T20:08:34Z" message: Connectivity restored after 2m59.999789186s start: "2021-01-13T20:08:34Z" startLogs: - latency: 3.483578ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: failed to establish a TCP connection to 10.0.0.4:6443: dial tcp 10.0.0.4:6443: connect: connection refused' reason: TCPConnectError success: false time: "2021-01-13T20:08:34Z" successes: - latency: 2.845865ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnect success: true time: "2021-01-13T21:14:34Z" - latency: 2.926345ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnect success: true time: "2021-01-13T21:13:34Z" - latency: 2.895796ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnect success: true time: "2021-01-13T21:12:34Z" - latency: 2.696844ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnect success: true time: "2021-01-13T21:11:34Z" - latency: 1.502064ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnect success: true time: "2021-01-13T21:10:34Z" - latency: 1.388857ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnect success: true time: "2021-01-13T21:09:34Z" - latency: 1.906383ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnect success: true time: "2021-01-13T21:08:34Z" - latency: 2.089073ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnect success: true time: "2021-01-13T21:07:34Z" - latency: 2.156994ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnect success: true time: "2021-01-13T21:06:34Z" - latency: 1.777043ms message: 'kubernetes-apiserver-endpoint-ci-ln-x5sv9rb-f76d1-4rzrp-master-0: tcp connection to 10.0.0.4:6443 succeeded' reason: TCPConnect success: true time: "2021-01-13T21:05:34Z"

第2章 クラスターネットワークの MTU 変更

クラスター管理者は、クラスターのインストール後にクラスターネットワークの最大転送単位 (MTU) を変更できます。MTU 変更の適用には、クラスターノードを再起動する必要があるため、変更により致命的な問題が発生する可能性があります。

2.1. クラスター MTU について

インストール時に、クラスターネットワークの最大伝送単位 (MTU) は、クラスターノードのプライマリーネットワークインターフェイスの MTU に基づいて自動的に設定されます。通常、検出された MTU を上書きする必要はありませんが、場合によっては上書きする必要があります。

場合によっては、次のいずれかの理由で、クラスターネットワークの MTU を変更する必要があります。

- クラスターのインストール中に検出された MTU が使用中のインフラストラクチャーに適していない

- クラスターインフラストラクチャーに異なる MTU が必要となった (例: パフォーマンスの最適化にさまざまな MTU を必要とするノードが追加された)。

OVN-Kubernetes ネットワークプラグインのみが MTU 値の変更をサポートしています。

2.1.1. サービス中断に関する考慮事項

クラスターで最大転送単位 (MTU) の変更を開始すると、サービスの可用性が次のような影響を受ける可能性があります。

- 新しい MTU への移行を完了するには、少なくとも 2 回のローリングリブートが必要です。この間、一部のノードは再起動するため使用できません。

- 特定のアプリケーションに、絶対 TCP タイムアウト間隔よりもタイムアウトの間隔が短いクラスターにデプロイされた場合など、MTU の変更中に中断が発生する可能性があります。

2.1.2. MTU 値の選択

最大転送単位 (MTU) の移行を計画する際には、2 つの MTU 値を考慮する必要があります。これらの値は、関連しているが異なるものです。

- ハードウェア MTU: この MTU 値は、ネットワークインフラストラクチャーの詳細に基づいて設定されます。

-

クラスターネットワーク MTU: この MTU 値は、クラスターネットワークオーバーレイのオーバーヘッドを考慮して、常にハードウェア MTU よりも小さくなります。具体的なオーバーヘッドは、ネットワークプラグインによって決まります。OVN-Kubernetes の場合、オーバーヘッドは

100バイトです。

クラスターがノードごとに異なる MTU 値を必要とする場合は、クラスター内の任意のノードで使用される最小の MTU 値から、ネットワークプラグインのオーバーヘッド値を差し引く必要があります。たとえば、クラスター内の一部のノードでは MTU が 9001 であり、MTU が 1500 のクラスターもある場合には、この値を 1400 に設定する必要があります。

ノードが受け入れられない MTU 値の選択を回避するには、ip -d link コマンドを使用して、ネットワークインターフェイスが受け入れる最大 MTU 値 (maxmtu) を確認します。

2.1.3. 移行プロセスの仕組み

以下の表は、プロセスのユーザーが開始する手順と、移行が応答として実行するアクション間を区分して移行プロセスを要約しています。

| ユーザーが開始する手順 | OpenShift Container Platform アクティビティー |

|---|---|

| Cluster Network Operator 設定で次の値を指定します。

| Cluster Network Operator (CNO): 各フィールドが有効な値に設定されていることを確認します。

指定の値が有効な場合に、CNO は、クラスターネットワークの MTU が Machine Config Operator (MCO): クラスター内の各ノードのローリングリブートを実行します。 |

| クラスター上のノードのプライマリーネットワークインターフェイスの MTU を再設定します。これは、次のいずれかの方法を使用して実行できます。

| 該当なし |

|

ネットワークプラグインの CNO 設定で | Machine Config Operator (MCO): 新しい MTU 設定を使用して、クラスター内の各ノードのローリングリブートを実行します。 |

2.2. クラスターネットワーク MTU の変更

クラスター管理者は、クラスターの最大伝送単位 (MTU) を増減できます。

MTU 移行プロセス中にノードの MTU 値をロールバックすることはできません。ただし、MTU 移行プロセスの完了後に値をロールバックすることはできます。

移行には中断が伴うため、MTU 更新が有効になると、クラスター内のノードが一時的に使用できなくなる可能性があります。

次の手順では、マシン設定、Dynamic Host Configuration Protocol (DHCP)、または ISO イメージを使用してクラスターネットワーク MTU を変更する方法を説明します。DHCP または ISO アプローチを使用する場合は、クラスターのインストール後に保持した設定アーティファクトを参照して、手順を完了する必要があります。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-admin権限を持つアカウントを使用してクラスターにアクセスできる。 -

クラスターのターゲット MTU を特定している。OVN-Kubernetes ネットワークプラグインの MTU は、クラスター内の最小のハードウェア MTU 値から

100を引いた値に設定する必要があります。 - ノードが物理マシンである場合は、クラスターネットワークと、接続されているネットワークスイッチがジャンボフレームをサポートしていることを確認する。

- ノードが仮想マシン (VM) である場合は、ハイパーバイザーと、接続されているネットワークスイッチがジャンボフレームをサポートしていることを確認する。

2.2.1. 現在のクラスターの MTU 値を確認する

クラスターの一部がクラウドにあり、一部がオンプレミス環境にあるハイブリッド環境でネットワークの安定性とパフォーマンスを確保するには、クラスターネットワークの現在の最大伝送単位 (MTU) を取得できます。

手順

クラスターネットワークの現在の MTU を取得するには、次のコマンドを入力します。

$ oc describe network.config cluster出力例

... Status: Cluster Network: Cidr: 10.217.0.0/22 Host Prefix: 23 Cluster Network MTU: 1400 Network Type: OVNKubernetes Service Network: 10.217.4.0/23 ...

2.2.2. ハードウェア MTU 設定の準備

MTU 変更時にネットワークの安定性を維持するには、DHCP、PXE、NetworkManager などの方法を使用して、基盤となるハードウェアの設定を準備する必要があります。この準備を行うことで、クラスターネットワークに変更を適用する前に、すべてのクラスターノードが新しい MTU 値を受け入れる準備ができていることを確認できます。

手順

ハードウェア MTU の設定を準備します。

ハードウェア MTU が DHCP で指定されている場合は、次の dnsmasq 設定などで DHCP 設定を更新します。

dhcp-option-force=26,<mtu>ここでは、以下のようになります。

<mtu>- DHCP サーバーがアドバタイズするハードウェア MTU を指定します。

- ハードウェア MTU が PXE を使用したカーネルコマンドラインで指定されている場合は、それに応じてその設定を更新します。

ハードウェア MTU が NetworkManager 接続設定で指定されている場合は、以下のステップを実行します。OpenShift Container Platform では、これは、DHCP、カーネルコマンドラインなどの方法でネットワーク設定を明示的に指定していない場合のデフォルトのアプローチです。変更なしで次の手順を機能させるには、全クラスターノードで、同じ基盤となるネットワーク設定を使用する必要があります。

次のコマンドを入力して、プライマリーネットワークインターフェイスを見つけます。

$ oc debug node/<node_name> -- chroot /host nmcli -g connection.interface-name c show ovs-if-phys0ここでは、以下のようになります。

<node_name>- クラスター内のノードの名前を指定します。

<interface>-mtu.confファイルに次のNetworkManager設定を作成します。[connection-<interface>-mtu] match-device=interface-name:<interface> ethernet.mtu=<mtu>ここでは、以下のようになります。

<interface>- プライマリーネットワークインターフェイス名を指定します。

<mtu>- 新しいハードウェア MTU 値を指定します。

2.2.3. MachineConfig オブジェクトの作成

ハードウェア MTU の変更に備えてノードを準備するには、コントロールプレーンノードとコンピュートノードの両方に対して MachineConfig オブジェクトを作成する必要があります。これらのオブジェクトを作成することで、更新されたネットワークインターフェイス設定が、クラスターの即時的な不安定性を引き起こすことなく、デプロイメント準備が整うことが保証されます。

手順

1 つはコントロールプレーンノード用、もう 1 つはクラスター内のワーカーノード用に、2 つの

MachineConfigオブジェクトを作成します。control-plane-interface.buファイルに次の Butane 設定を作成します。注記設定ファイルで指定する Butane のバージョン は、OpenShift Container Platform のバージョンと同じである必要があり、末尾は常に

0です。たとえば、4.20.0などです。Butane の詳細は、「Butane を使用したマシン設定の作成」を参照してください。variant: openshift version: 4.20.0 metadata: name: 01-control-plane-interface labels: machineconfiguration.openshift.io/role: master storage: files: - path: /etc/NetworkManager/conf.d/99-<interface>-mtu.conf contents: local: <interface>-mtu.conf mode: 0600ここでは、以下のようになります。

ストレージファイルパス-

プライマリーネットワークインターフェイスの

NetworkManager接続名を指定します。 ストレージ.ファイル.ローカル-

前のステップで更新された

NetworkManager設定ファイルのローカルファイル名を指定します。

worker-interface.buファイルに次の Butane 設定を作成します。注記設定ファイルで指定する Butane のバージョン は、OpenShift Container Platform のバージョンと同じである必要があり、末尾は常に

0です。たとえば、4.20.0などです。Butane の詳細は、「Butane を使用したマシン設定の作成」を参照してください。variant: openshift version: 4.20.0 metadata: name: 01-worker-interface labels: machineconfiguration.openshift.io/role: worker storage: files: - path: /etc/NetworkManager/conf.d/99-<interface>-mtu.conf contents: local: <interface>-mtu.conf mode: 0600ここでは、以下のようになります。

ストレージファイルパス-

プライマリーネットワークインターフェイスの

NetworkManager接続名を指定します。 ストレージ.ファイル.ローカル-

前のステップで更新された

NetworkManager設定ファイルのローカルファイル名を指定します。

次のコマンドを実行して、Butane 設定から

MachineConfigオブジェクトを作成します。$ for manifest in control-plane-interface worker-interface; do butane --files-dir . $manifest.bu > $manifest.yaml done警告これらのマシン設定は、後で明示的に指示されるまで適用しないでください。これらのマシン設定を適用すると、クラスターの安定性が失われます。

2.2.4. MTU の移行の開始

クラスターネットワークとマシンインターフェイスの移行設定を指定して、最大伝送単位 (MTU) の移行を開始します。Machine Config Operator は、MTU 変更に備えてクラスターを準備するために、ノードのローリング再起動を実行します。

手順

MTU の移行を開始するには、次のコマンドを入力して移行設定を指定します。Machine Config Operator は、MTU の変更に備えて、クラスター内のノードをローリングリブートします。

$ oc patch Network.operator.openshift.io cluster --type=merge --patch \ '{"spec": { "migration": { "mtu": { "network": { "from": <overlay_from>, "to": <overlay_to> } , "machine": { "to" : <machine_to> } } } } }'ここでは、以下のようになります。

<overlay_from>- 現在のクラスターネットワークの MTU 値を指定します。

<overlay_to>-

クラスターネットワークのターゲット MTU を指定します。この値は、

<machine_to>の値を基準にして設定します。OVN-Kubernetes の場合、この値は<machine_to>の値から100を引いた値である必要があります。 <machine_to>- 基盤となるホストネットワークのプライマリーネットワークインターフェイスの MTU を指定します。

$ oc patch Network.operator.openshift.io cluster --type=merge --patch \ '{"spec": { "migration": { "mtu": { "network": { "from": 1400, "to": 9000 } , "machine": { "to" : 9100} } } } }'Machine Config Operator は、各マシン設定プール内のマシンを更新するときに、各ノードを 1 つずつ再起動します。すべてのノードが更新されるまで待機する必要があります。以下のコマンドを実行してマシン設定プールのステータスを確認します。

$ oc get machineconfigpools正常に更新されたノードには、

UPDATED=true、UPDATING=false、DEGRADED=falseのステータスがあります。注記Machine Config Operator は、デフォルトでプールごとに 1 つずつマシンを更新するため、クラスターのサイズに応じて移行にかかる合計時間が増加します。

2.2.5. マシン設定の検証

ホストマシンの設定を確認し、最大伝送単位 (MTU) の移行が正常に適用されたことを確認してください。設定状態とシステム設定を確認することで、ノードが正しい移行スクリプトを使用していることを確認できます。

手順

ホスト上の新規マシン設定のステータスを確認します。

マシン設定の状態と適用されたマシン設定の名前をリスト表示するには、以下のコマンドを入力します。

$ oc describe node | egrep "hostname|machineconfig"出力例

kubernetes.io/hostname=master-0 machineconfiguration.openshift.io/currentConfig: rendered-master-c53e221d9d24e1c8bb6ee89dd3d8ad7b machineconfiguration.openshift.io/desiredConfig: rendered-master-c53e221d9d24e1c8bb6ee89dd3d8ad7b machineconfiguration.openshift.io/reason: machineconfiguration.openshift.io/state: Done以下のステートメントが true であることを確認します。

-

machineconfiguration.openshift.io/stateフィールドの値はDoneです。 -

machineconfiguration.openshift.io/currentConfigフィールドの値は、machineconfiguration.openshift.io/desiredConfigフィールドの値と等しくなります。

-

マシン設定が正しいことを確認するには、以下のコマンドを入力します。

$ oc get machineconfig <config_name> -o yaml | grep ExecStartここでは、以下のようになります。

<config_name>-

machineconfiguration.openshift.io/currentConfigフィールドからマシン設定の名前を指定します。

マシン設定には、systemd 設定に以下の更新を含める必要があります。

ExecStart=/usr/local/bin/mtu-migration.sh

2.2.6. 新しいハードウェア MTU 値の適用

クラスター全体で一貫したネットワーク通信を確保するには、新しいハードウェア最大伝送単位 (MTU) 値をノードに適用する必要があります。このプロセスには、基盤となるネットワークインターフェイスの更新と、Machine Config Operator が各ノードを正常に再起動および更新したことを確認する作業が含まれます。

手順

基盤となるネットワークインターフェイスの MTU 値を更新します。

NetworkManager 接続設定で新しい MTU を指定する場合は、次のコマンドを入力します。MachineConfig Operator は、クラスター内のノードのローリングリブートを自動的に実行します。

$ for manifest in control-plane-interface worker-interface; do oc create -f $manifest.yaml done- DHCP サーバーオプションまたはカーネルコマンドラインと PXE を使用して新しい MTU を指定する場合は、インフラストラクチャーに必要な変更を加えます。

Machine Config Operator は、各マシン設定プール内のマシンを更新するときに、各ノードを 1 つずつ再起動します。すべてのノードが更新されるまで待機する必要があります。以下のコマンドを実行してマシン設定プールのステータスを確認します。

$ oc get machineconfigpools正常に更新されたノードには、

UPDATED=true、UPDATING=false、DEGRADED=falseのステータスがあります。注記Machine Config Operator は、デフォルトでプールごとに 1 つずつマシンを更新するため、クラスターのサイズに応じて移行にかかる合計時間が増加します。

ホスト上の新規マシン設定のステータスを確認します。

マシン設定の状態と適用されたマシン設定の名前をリスト表示するには、以下のコマンドを入力します。

$ oc describe node | egrep "hostname|machineconfig"出力例

kubernetes.io/hostname=master-0 machineconfiguration.openshift.io/currentConfig: rendered-master-c53e221d9d24e1c8bb6ee89dd3d8ad7b machineconfiguration.openshift.io/desiredConfig: rendered-master-c53e221d9d24e1c8bb6ee89dd3d8ad7b machineconfiguration.openshift.io/reason: machineconfiguration.openshift.io/state: Done以下のステートメントが true であることを確認します。

-

machineconfiguration.openshift.io/stateフィールドの値はDoneです。 -

machineconfiguration.openshift.io/currentConfigフィールドの値は、machineconfiguration.openshift.io/desiredConfigフィールドの値と等しくなります。

-

マシン設定が正しいことを確認するには、以下のコマンドを入力します。

$ oc get machineconfig <config_name> -o yaml | grep path:ここでは、以下のようになります。

<config_name>-

machineconfiguration.openshift.io/currentConfigフィールドからマシン設定の名前を指定します。

マシン設定が正常にデプロイされた場合、前の出力には

/etc/NetworkManager/conf.d/99-<interface>-mtu.confファイルパスとExecStart=/usr/local/bin/mtu-migration.sh行が含まれます。

2.2.7. MTU の移行の完了

OVN-Kubernetes ネットワークプラグインに新しい最大伝送単位 (MTU) 設定を適用するために、MTU 移行を完了します。これによりクラスター設定が更新され、プロセスを完了するためにノードのローリングリブートがトリガーされます。

手順

MTU の移行を完了するために、OVN-Kubernetes ネットワークプラグインに対して次のコマンドを入力します。

$ oc patch Network.operator.openshift.io cluster --type=merge --patch \ '{"spec": { "migration": null, "defaultNetwork":{ "ovnKubernetesConfig": { "mtu": <mtu> }}}}'ここでは、以下のようになります。

<mtu>-

<overlay_to>で指定した新しいクラスターネットワーク MTU を指定します。

MTU の移行が完了すると、各マシン設定プールノードが 1 つずつ再起動します。すべてのノードが更新されるまで待機する必要があります。以下のコマンドを実行してマシン設定プールのステータスを確認します。

$ oc get machineconfigpools正常に更新されたノードには、

UPDATED=true、UPDATING=false、DEGRADED=falseのステータスがあります。

検証

クラスターネットワークの現在の MTU を取得するには、次のコマンドを入力します。

$ oc describe network.config clusterノードのプライマリーネットワークインターフェイスの現在の MTU を取得します。

クラスター内のノードをリスト表示するには、次のコマンドを入力します。

$ oc get nodesノードのプライマリーネットワークインターフェイスの現在の MTU 設定を取得するには、次のコマンドを入力します。

$ oc adm node-logs <node> -u ovs-configuration | grep configure-ovs.sh | grep mtu | grep <interface> | head -1ここでは、以下のようになります。

<node>- 前のステップの出力をもとに、ノードを指定します。

<interface>- ノードのプライマリーネットワークインターフェイス名を指定します。

出力例

ens3: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 8051

第3章 ネットワーク結合に関する考慮事項

ネットワークボンディング (リンクアグリゲーション とも呼ばれる) を使用すると、複数のネットワークインターフェイスを単一の論理インターフェイスに統合できます。これは、ボンディングされたインターフェイス間でネットワークトラフィックをどのように分散させるかを処理するために、異なるモードを使用できることを意味します。各モードは耐障害性を提供し、一部のモードではネットワークの負荷分散機能も提供します。Red Hat は、Open vSwitch (OVS) ボンディングとカーネルボンディングをサポートしています。

3.1. Open vSwitch (OVS) ボンディング

OVS ボンディング設定では、各物理ネットワークインターフェイスコントローラー (NIC) を特定のボンディングのポートとして接続することにより、単一の論理インターフェイスを作成します。この単一のボンディングがすべてのネットワークトラフィックを処理し、個々のインターフェイスの機能を効果的に代替します。

OVS インターフェイスと連携する OVS ブリッジのアーキテクチャー設定として、以下の例を検討してください。

- ネットワークインターフェイスは、プロトコルレベルのトラフィックや IP アドレスの割り当てなどのその他の管理タスクを管理するために、ブリッジ Media Access Control (MAC) アドレスを使用します。

- 物理インターフェイスの物理 MAC アドレスは、トラフィックを処理しません。

- OVS は、OVS ブリッジレベルで全ての MAC アドレス管理を処理します。

このレイアウトでは、ボンディングがデータパスとして機能し、MAC アドレスの一元管理が OVS ブリッジレベルで行われるため、ボンディングインターフェイスの管理が簡素化されます。

OVS ボンディングでは、アクティブ/バックアップ モードまたは バランス/SLB モードのいずれかを選択できます。ボンディングモードは、ネットワーク伝送中にボンディングインターフェイスがどのように使用されるかに関するポリシーを指定します。

3.1.1. クラスターのアクティブ/バックアップモードを有効にしてください

アクティブ/バックアップ モードは、プライマリーリンクに障害が発生した場合にバックアップリンクに切り替えることで、ネットワーク接続の耐障害性を提供します。

このモードでは、クラスター用に以下のポートを指定します。

- アクティブなポートとは、常に 1 つの物理インターフェイスがトラフィックの送受信を行うポートのことです。

- 他のすべてのポートがバックアップリンクとして機能し、リンクの状態を継続的に監視するスタンバイポート。

フェイルオーバー処理中に、アクティブポートまたはそのリンクに障害が発生した場合、ボンディングロジックによってすべてのネットワークトラフィックがスタンバイポートに切り替わります。このスタンバイポートが新しいアクティブポートになります。フェイルオーバーを機能させるには、ボンディングされたすべてのポートが同じ Media Access Control (MAC) アドレスを共有している必要があります。

3.1.2. クラスターで OVS balance-slb モードを有効にする

2 つ以上の物理インターフェイスがネットワークトラフィックを共有できるように、Open vSwitch (OVS) の balance-slb モードを有効にできます。balance-slb モードのインターフェイスは、ネットワークスイッチとのソースロードバランシングを必要とせずに、仮想化ワークロードを実行するクラスターにソース負荷分散 (SLB) 機能を提供できます。

現在、ソースロードバランシングはボンディングインターフェイスで実行されます。このインターフェイスは br-phy などの補助ブリッジに接続します。ソースロードバランシングは、Media Access Control (MAC) アドレスと仮想ローカルエリアネットワーク (VLAN) の組み合わせが複数存在する場合にのみ、負荷分散を行います。OVN-Kubernetes Pod のトラフィックはすべて同じ MAC アドレスと VLAN を使用するため、このトラフィックを多数の物理インターフェイス間で負荷分散することはできないことに注意してください。

次の図は、単純なクラスターインフラストラクチャーレイアウトでの balance-slb モードを示しています。仮想マシン (VM) は、特定の localnet NetworkAttachmentDefinition (NAD) カスタムリソース定義 (CRD)、NAD 0 または NAD 1 に接続します。各 NAD は、仮想マシンに基盤となる物理ネットワークへのアクセスを提供し、タグ付きまたはタグなしの VLAN トラフィックをサポートしています。br-ex OVS ブリッジは仮想マシンからのトラフィックを受信し、そのトラフィックを次の OVS ブリッジである br-phy に渡します。br-phy ブリッジは SLB ボンディングのコントローラーとして機能します。SLB ボンディングは、eno0 や eno1 などの物理インターフェイスリンクを介して、異なる仮想マシンポートからのトラフィックを分散します。さらに、どちらの物理インターフェイスからの Ingress トラフィックも、OVS ブリッジのセットを通過して仮想マシンに到達できます。

図3.1 2 つの NAD を持つローカルネット上で動作する OVS balance-slb モード

OVS ボンディングを使用して、balance-slb モードインターフェイスをプライマリーまたはセカンダリーネットワークタイプに統合できます。OVS ボンディングでは、次の点に注意してください。

- OVN-Kubernetes CNI プラグインをサポートし、プラグインと簡単に統合できます。

-

ネイティブで

balance-slbモードをサポートします。

前提条件

-

プライマリーネットワークに複数の物理インターフェイスが接続されており、それらのインターフェイスを

MachineConfigファイルで定義した。 -

マニフェストオブジェクトを作成し、カスタマイズした

br-exブリッジをオブジェクト設定ファイルで定義した。 - プライマリーネットワークに複数の物理インターフェイスが接続されており、それらのインターフェイスを NAD CRD ファイルで定義した。

手順

クラスター内に存在するベアメタルホストごとに、クラスターの

install-config.yamlファイルで、次の例のようにnetworkConfigセクションを定義します。# ... networkConfig: interfaces: - name: enp1s0 type: ethernet state: up ipv4: dhcp: true enabled: true ipv6: enabled: false - name: enp2s0 type: ethernet state: up mtu: 1500 ipv4: dhcp: true enabled: true ipv6: dhcp: true enabled: true - name: enp3s0 type: ethernet state: up mtu: 1500 ipv4: enabled: false ipv6: enabled: false # ...ここでは、以下のようになります。

enp1s0- プロビジョニングされるネットワークインターフェイスコントローラー (NIC) のインターフェイス。

enp2s0- ボンディングインターフェイス用の Ignition 設定ファイルを取り込む最初のボンディングされたインターフェイス。

mtu-

ボンディングポートの

br-ex最大伝送単位 (MTU) を手動で設定します。 enp3s0- 2 つ目のボンディングされたインターフェイスは、クラスターのインストール中に Ignition を実行する最小設定の一部です。

NMState 設定ファイルで各ネットワークインターフェイスを定義します。

多数のネットワークインターフェイスを定義する NMState 設定ファイルの例

ovn: bridge-mappings: - localnet: localnet-network bridge: br-ex state: present interfaces: - name: br-ex type: ovs-bridge state: up bridge: allow-extra-patch-ports: true port: - name: br-ex - name: patch-ex-to-phy ovs-db: external_ids: bridge-uplink: "patch-ex-to-phy" - name: br-ex type: ovs-interface state: up mtu: 1500 ipv4: enabled: true dhcp: true auto-route-metric: 48 ipv6: enabled: false dhcp: false auto-route-metric: 48 - name: br-phy type: ovs-bridge state: up bridge: allow-extra-patch-ports: true port: - name: patch-phy-to-ex - name: ovs-bond link-aggregation: mode: balance-slb port: - name: enp2s0 - name: enp3s0 - name: patch-ex-to-phy type: ovs-interface state: up patch: peer: patch-phy-to-ex - name: patch-phy-to-ex type: ovs-interface state: up patch: peer: patch-ex-to-phy - name: enp1s0 type: ethernet state: up ipv4: dhcp: true enabled: true ipv6: enabled: false - name: enp2s0 type: ethernet state: up mtu: 1500 ipv4: enabled: false ipv6: enabled: false - name: enp3s0 type: ethernet state: up mtu: 1500 ipv4: enabled: false ipv6: enabled: false # ...ここでは、以下のようになります。

mtu-

ボンディングポートの

br-exMTU を手動で設定します。

base64コマンドを使用して、NMState 設定ファイルのインターフェイスコンテンツをエンコードします。$ base64 -w0 <nmstate_configuration>.yml<nmstate_configuration>:-w0オプションは、base64 エンコード操作中の行折り返しを防止します。masterロールとworkerロールのMachineConfigマニフェストファイルを作成します。前のコマンドからの base64 エンコード文字列を各MachineConfigマニフェストファイルに必ず埋め込んでください。次のマニフェストファイルの例では、クラスター内に存在するすべてのノードに対してmasterロールを設定します。ノード固有のmasterロールとworkerロールのマニフェストファイルを作成することもできます。apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: master name: 10-br-ex-master spec: config: ignition: version: 3.2.0 storage: files: - contents: source: data:text/plain;charset=utf-8;base64,<base64_encoded_nmstate_configuration> mode: 0644 overwrite: true path: /etc/nmstate/openshift/cluster.ymlここでは、以下のようになります。

name- ポリシーの名前。

source- エンコードされた base64 情報を指定されたパスに書き込みます。

path-

cluster.ymlファイルへのパスを指定します。クラスター内の各ノードに対して、<node_short_hostname>.yml など、ノードへの短いホスト名パスを指定できます。

各

MachineConfigマニフェストファイルを./<installation_directory>/manifestsディレクトリーに保存します。<installation_directory>は、インストールプログラムがファイルを作成するディレクトリーです。Machine Config Operator (MCO) が各マニフェストファイルからコンテンツを取得し、ローリング更新中に選択されたすべてのノードにそのコンテンツを一貫して適用します。

3.2. カーネル結合

カーネルボンディング (Linux カーネルに組み込まれた機能で、複数のイーサネットインターフェイス間でリンクアグリゲーションを行う機能) を使用することで、単一の論理的な物理インターフェイスを作成できます。カーネルボンディングにより、複数のネットワークインターフェイスを単一の論理インターフェイスに結合することが可能になり、帯域幅の増加やリンク障害発生時の冗長性確保によってネットワークパフォーマンスを向上させることができます。

OVS ボンディングに依存するボンディングインターフェイスがない場合、カーネルボンディングがデフォルトモードになります。このボンディング方式では、サポートされている OVS ボンディングと同等のカスタマイズ性は得られません。

カーネルボンディング モードの場合、ボンディングインターフェイスはブリッジインターフェイスの外部に存在し、つまりデータパス内には存在しません。このモードでは、ネットワークトラフィックはボンディングインターフェイスポート上で送受信されず、代わりにカーネルレベルでの MAC アドレス割り当てのための追加のブリッジング機能が必要となります。

ノードのネットワークコントローラーインターフェイス (NIC) で カーネルボンディング モードを有効にした場合、Media Access Control (MAC) アドレスのフェイルオーバーを指定する必要があります。この設定により、eno1f0 や eno2f0 などのボンディングインターフェイスとのノード通信の問題が防止されます。

Red Hat は fail_over_mac パラメーターに対して以下の値のみをサポートしています。

-

0:noneを指定します。これにより、MAC アドレスのフェイルオーバーが無効になり、すべてのインターフェイスがボンディングインターフェイスと同じ MAC アドレスを受け取ります。これはデフォルト値です。

Red Hat は fail_over_mac パラメーターに対して以下の値をサポートしていません。

-

1:アクティブ値を指定し、プライマリーボンディングインターフェイスの MAC アドレスを常にアクティブなインターフェイスと同じに設定します。フェイルオーバー中にインターフェイスの MAC アドレスが変更された場合、ボンディングインターフェイスの MAC アドレスも、新しい MAC アドレスに合わせて変更されます。 -

2: フェイルオーバー時に、アクティブなインターフェイスがボンディングインターフェイスの MAC アドレスを取得し、以前アクティブだったインターフェイスが新しくアクティブになったインターフェイスの MAC アドレスを取得するように、フォロー値を指定します。

第4章 Stream Control Transmission Protocol (SCTP) の使用

クラスター管理者は、ベアメタルクラスターで Stream Control Transmission Protocol (SCTP) を使用できます。

4.1. OpenShift Container Platform での SCTP のサポート

クラスター管理者は、クラスターのホストで SCTP を有効にできます。Red Hat Enterprise Linux CoreOS (RHCOS) で、SCTP モジュールはデフォルトで無効にされています。

SCTP は、IP ネットワークの上部で実行される信頼できるメッセージベースのプロトコルです。

これを有効にすると、SCTP を Pod、サービス、およびネットワークポリシーでプロトコルとして使用できます。Service オブジェクトは、type パラメーターを ClusterIP または NodePort のいずれかの値に設定して定義する必要があります。

4.1.1. SCTP プロトコルを使用した設定例

protocol パラメーターを Pod またはサービスリソース定義の SCTP 値に設定して、Pod またはサービスを SCTP を使用するように設定できます。

以下の例では、Pod は SCTP を使用するように設定されています。

apiVersion: v1

kind: Pod

metadata:

namespace: project1

name: example-pod

spec:

containers:

- name: example-pod

...

ports:

- containerPort: 30100

name: sctpserver

protocol: SCTP以下の例では、サービスは SCTP を使用するように設定されています。

apiVersion: v1

kind: Service

metadata:

namespace: project1

name: sctpserver

spec:

...

ports:

- name: sctpserver

protocol: SCTP

port: 30100

targetPort: 30100

type: ClusterIP

以下の例では、NetworkPolicy オブジェクトは、特定のラベルの付いた Pod からポート 80 の SCTP ネットワークトラフィックに適用するように設定されます。

kind: NetworkPolicy

apiVersion: networking.k8s.io/v1

metadata:

name: allow-sctp-on-http

spec:

podSelector:

matchLabels:

role: web

ingress:

- ports:

- protocol: SCTP

port: 804.2. SCTP (Stream Control Transmission Protocol) の有効化

クラスター管理者は、クラスターのワーカーノードでブラックリストに指定した SCTP カーネルモジュールを読み込み、有効にできます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-adminロールを持つユーザーとしてクラスターにアクセスできる。

手順

以下の YAML 定義が含まれる

load-sctp-module.yamlという名前のファイルを作成します。apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: name: load-sctp-module labels: machineconfiguration.openshift.io/role: worker spec: config: ignition: version: 3.2.0 storage: files: - path: /etc/modprobe.d/sctp-blacklist.conf mode: 0644 overwrite: true contents: source: data:, - path: /etc/modules-load.d/sctp-load.conf mode: 0644 overwrite: true contents: source: data:,sctpMachineConfigオブジェクトを作成するには、以下のコマンドを入力します。$ oc create -f load-sctp-module.yamlオプション: MachineConfig Operator が設定変更を適用している間にノードのステータスを確認するには、以下のコマンドを入力します。ノードのステータスが

Readyに移行すると、設定の更新が適用されます。$ oc get nodes

4.3. SCTP (Stream Control Transmission Protocol) が有効になっていることの確認

SCTP がクラスターで機能することを確認するには、SCTP トラフィックをリッスンするアプリケーションで Pod を作成し、これをサービスに関連付け、公開されたサービスに接続します。

前提条件

-

クラスターからインターネットにアクセスし、

ncパッケージをインストールすること。 -

OpenShift CLI (

oc) がインストールされている。 -

cluster-adminロールを持つユーザーとしてクラスターにアクセスできる。

手順

SCTP リスナーを起動する Pod を作成します。

以下の YAML で Pod を定義する

sctp-server.yamlという名前のファイルを作成します。apiVersion: v1 kind: Pod metadata: name: sctpserver labels: app: sctpserver spec: containers: - name: sctpserver image: registry.access.redhat.com/ubi9/ubi command: ["/bin/sh", "-c"] args: ["dnf install -y nc && sleep inf"] ports: - containerPort: 30102 name: sctpserver protocol: SCTP以下のコマンドを入力して Pod を作成します。

$ oc create -f sctp-server.yaml

SCTP リスナー Pod のサービスを作成します。

以下の YAML でサービスを定義する

sctp-service.yamlという名前のファイルを作成します。apiVersion: v1 kind: Service metadata: name: sctpservice labels: app: sctpserver spec: type: NodePort selector: app: sctpserver ports: - name: sctpserver protocol: SCTP port: 30102 targetPort: 30102サービスを作成するには、以下のコマンドを入力します。

$ oc create -f sctp-service.yaml

SCTP クライアントの Pod を作成します。

以下の YAML で

sctp-client.yamlという名前のファイルを作成します。apiVersion: v1 kind: Pod metadata: name: sctpclient labels: app: sctpclient spec: containers: - name: sctpclient image: registry.access.redhat.com/ubi9/ubi command: ["/bin/sh", "-c"] args: ["dnf install -y nc && sleep inf"]Podオブジェクトを作成するには、以下のコマンドを入力します。$ oc apply -f sctp-client.yaml

サーバーで SCTP リスナーを実行します。

サーバー Pod に接続するには、以下のコマンドを入力します。

$ oc rsh sctpserverSCTP リスナーを起動するには、以下のコマンドを入力します。

$ nc -l 30102 --sctp

サーバーの SCTP リスナーに接続します。

- ターミナルプログラムで新規のターミナルウィンドウまたはタブを開きます。

sctpserviceサービスの IP アドレスを取得します。以下のコマンドを入力します。$ oc get services sctpservice -o go-template='{{.spec.clusterIP}}{{"\n"}}'クライアント Pod に接続するには、以下のコマンドを入力します。

$ oc rsh sctpclientSCTP クライアントを起動するには、以下のコマンドを入力します。

<cluster_IP>をsctpserviceサービスのクラスター IP アドレスに置き換えます。# nc <cluster_IP> 30102 --sctp

第5章 セカンダリーインターフェイスメトリクスのネットワーク割り当てへの関連付け

クラスターのトラフィックをより詳細に把握するために、セカンダリーインターフェイスのメトリクスを特定のネットワークアタッチメントに関連付けることができます。pod_network_info メトリクスを使用して、NetworkAttachmentDefinition リソースに基づいてインターフェイスにラベルを付けることで、ネットワーク全体のパフォーマンスをより簡単に監視し、接続の問題をトラブルシューティングできます。

5.1. モニタリングのためのセカンダリーネットワークメトリクスの拡張

ネットワークトラフィックを効果的に監視および管理するには、識別情報を追加して二次的なネットワークメトリクスを拡張することができます。pod_network_name_info メトリクスを使用して、NetworkAttachmentDefinition リソースに基づいてインターフェイスにラベルを付けることで、インターフェイスの種類を分類し、正確なメトリクス集計とアラートが可能になります。

セカンダリーデバイス (インターフェイス) は、各種の用途に合わせて使用されます。効果的な集約と監視を可能にするには、セカンダリーネットワークインターフェイスからのメトリクスを分類する必要があります。

公開されるメトリクスにはインターフェイスが含まれますが、インターフェイスの出所は指定されません。これは、追加のインターフェイスがない場合に実行できます。ただし、セカンダリーインターフェイスが追加された場合、インターフェイス名のみに依存すると、その目的を識別してメトリクスを効果的に使用することが困難になるため、問題が発生します。

セカンダリーインターフェイスを追加する場合、名前は追加された順序によって異なります。セカンダリーインターフェイスは、それぞれ異なる目的に使用できる別のネットワークに属することができます。

pod_network_name_info を使用すると、現在のメトリクスをインターフェイスタイプを識別する追加情報を使用して拡張できます。このようにして、メトリクスを集約し、特定のインターフェイスタイプに特定のアラームを追加できます。

ネットワークタイプは、それぞれのセカンダリーネットワーククラスを区別する NetworkAttachmentDefinition リソースの名前から生成されます。たとえば、異なるネットワークに属するインターフェイスや、異なる CNI を使用するインターフェイスは、異なるネットワーク割り当て定義名を使用します。

5.2. Network Metrics Daemon

ネットワークメトリクスデーモンは、複雑な Pod 環境におけるパフォーマンス管理をサポートするために、ネットワーク関連のメトリクスを収集して公開します。このコンポーネントは、セカンダリーインターフェイスのメタデータを提供します。これは、異なるネットワークアタッチメント間での正確なトラフィック監視に必要です。

kubelet はすでに確認できるネットワーク関連のメトリクスを公開しています。以下は、これらのメトリクスになります。

-

container_network_receive_bytes_total -

container_network_receive_errors_total -

container_network_receive_packets_total -

container_network_receive_packets_dropped_total -

container_network_transmit_bytes_total -

container_network_transmit_errors_total -

container_network_transmit_packets_total -

container_network_transmit_packets_dropped_total

これらのメトリクスのラベルには、とくに以下が含まれます。

- Pod の名前

- Pod の namespace

-

インターフェイス名 (例:

eth0)

これらのメトリクスは、たとえば Multus を使用して、新規インターフェイスが Pod に追加されるまで正常に機能します。

インターフェイスのラベルはインターフェイス名を参照しますが、そのインターフェイスの用途は明確ではありません。多くの異なるインターフェイスがある場合、監視しているメトリクスが参照するネットワークを把握することはできません。

これには、以降のセクションで説明する新規の pod_network_name_info を導入して対応できます。

5.3. ネットワーク名を持つメトリクス

セカンダリーネットワークの監視を簡素化するために、pod_network_name_info メトリクスを使用して、ネットワークパフォーマンスデータを特定のネットワーク名と関連付けることができます。このメトリクスをコンテナーネットワークメトリクスと組み合わせることで、異なるネットワークアタッチメント定義全体にわたるトラフィックパターンとエラーを特定できます。

pod_network_name_info の例

pod_network_name_info{interface="net0",namespace="namespacename",network_name="nadnamespace/firstNAD",pod="podname"} 0

ネットワーク名ラベルは、Multus によって追加されるアノテーションを使用して生成されます。これは、ネットワークの割り当て定義が属する namespace の連結と、ネットワーク割り当て定義の名前です。Network Metrics daemonset は、固定の値が 0 の pod_network_name_info 測定メトリクスを公開します。

新しいメトリクスのみでは十分な値が提供されませんが、ネットワーク関連の container_network_* メトリクスと組み合わせて、セカンダリーネットワークの監視に対するサポートを強化します。

以下のような promql クエリーを使用すると、k8s.v1.cni.cncf.io/network-status アノテーションから取得した値とネットワーク名を含む新規のメトリクスを取得できます。

(container_network_receive_bytes_total) + on(namespace,pod,interface) group_left(network_name) ( pod_network_name_info )

(container_network_receive_errors_total) + on(namespace,pod,interface) group_left(network_name) ( pod_network_name_info )

(container_network_receive_packets_total) + on(namespace,pod,interface) group_left(network_name) ( pod_network_name_info )

(container_network_receive_packets_dropped_total) + on(namespace,pod,interface) group_left(network_name) ( pod_network_name_info )

(container_network_transmit_bytes_total) + on(namespace,pod,interface) group_left(network_name) ( pod_network_name_info )

(container_network_transmit_errors_total) + on(namespace,pod,interface) group_left(network_name) ( pod_network_name_info )

(container_network_transmit_packets_total) + on(namespace,pod,interface) group_left(network_name) ( pod_network_name_info )

(container_network_transmit_packets_dropped_total) + on(namespace,pod,interface) group_left(network_name)第6章 BGP ルーティング

6.1. BGP ルーティングについて

この機能は、クラスターにネイティブの Border Gateway Protocol (BGP) ルーティング機能を提供します。

MetalLB Operator を使用しており、クラスター管理者、または MetalLB Operator 以外のサードパーティークラスターコンポーネントによって作成された metallb-system namespace に既存の FRRConfiguration CR がある場合は、それらが openshift-frr-k8s namespace にコピーされているか、そのサードパーティークラスターコンポーネントが新しい namespace を使用していることを確認する必要があります。詳細は、FRR-K8s リソースの移行 を参照してください。

6.1.1. Border Gateway Protocol (BGP) ルーティングについて

OpenShift Container Platform は、FRRouting (FRR) を通じて BGP ルーティングをサポートします。FRR は、Linux、UNIX、および同様のオペレーティングシステム向けの無料のオープンソースインターネットルーティングプロトコルスイートです。FRR-K8s は、Kubernetes に準拠した方法で FRR API のサブセットを公開する Kubernetes ベースのデーモンセットです。クラスター管理者は、FRRConfiguration カスタムリソース (CR) を使用して FRR サービスにアクセスできます。

6.1.1.1. サポートされているプラットフォーム

BGP ルーティングは、次のインフラストラクチャータイプでサポートされています。

- ベアメタル

BGP ルーティングでは、ネットワークプロバイダーに対して BGP が適切に設定されている必要があります。ネットワークプロバイダーの停止や設定ミスにより、クラスターネットワークが中断される可能性があります。

6.1.1.2. MetalLB Operator の使用に関する考慮事項

MetalLB Operator は、クラスターへのアドオンとしてインストールされます。MetalLB Operator をデプロイすると、FRR-K8s が追加のルーティング機能プロバイダーとして自動的に有効になり、この機能によってインストールされた FRR-K8s デーモンが使用されます。

4.18 にアップグレードする前に、MetalLB Operator によって管理されていない metallb-system namespace 内の既存の FRRConfiguration (クラスター管理者またはその他のコンポーネントにより追加) を、openshift-frr-k8s namespace に手動でコピーし、必要に応じて namespace を作成する必要があります。

MetalLB Operator を使用しており、クラスター管理者、または MetalLB Operator 以外のサードパーティークラスターコンポーネントによって作成された既存の FRRConfiguration CR が metallb-system namespace に存在する場合は、次の操作を行う必要があります。

-

既存の

FRRConfigurationCR がopenshift-frr-k8snamespace にコピーされていることを確認します。 -

サードパーティークラスターコンポーネントが、作成する

FRRConfigurationCR に新しい namespace を使用することを確認します。

6.1.1.3. Cluster Network Operator の設定

Cluster Network Operator API は、BGP ルーティングを設定するために次の API フィールドを公開します。

-

spec.additionalRoutingCapabilities: ルートアドバタイズメントとは独立して使用できるクラスターの FRR-K8s デーモンのデプロイメントを有効にします。有効にすると、FRR-K8s デーモンがすべてのノードにデプロイされます。

6.1.1.4. BGP ルーティングカスタムリソース

BGP ルーティングの設定には、次のカスタムリソースが使用されます。

FRRConfiguration- このカスタムリソースは、BGP ルーティングの FRR 設定を定義します。この CR には namespace があります。

6.1.2. FRRConfiguration CRD の設定

MetalLB の標準機能を超えてルーティング動作をカスタマイズするには、FRRConfiguration カスタムリソース (CR) を設定します。

以下の参考例は、受信ルートなどの高度なサービスを有効にするために、特定の FRRouting (FRR) パラメーターを定義する方法を示しています。

ルーターパラメーター-

routersパラメーターを使用すると、Virtual Routing and Forwarding (VRF) リソースごとに 1 つのルーターを設定して、複数のルーターを設定することができます。各ルーターに AS 番号 (ASN) を定義する必要があります。

次の例のように、接続する Border Gateway Protocol (BGP) の近隣のリストを定義することもできます。

FRRConfiguration CR の例

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: test

namespace: frr-k8s-system

spec:

bgp:

routers:

- asn: 64512

neighbors:

- address: 172.30.0.3

asn: 4200000000

ebgpMultiHop: true

port: 180

- address: 172.18.0.6

asn: 4200000000

port: 179

# ...toAdvertiseパラメーター-

デフォルトでは、

FRR-K8sはルーター設定の一部として設定された接頭辞をアドバタイズしません。プレフィックスを通知するには、toAdvertiseパラメーターを使用します。

次の例のように、接頭辞のサブセットをアドバタイズできます。

FRRConfiguration CR の例

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: test

namespace: frr-k8s-system

spec:

bgp:

routers:

- asn: 64512

neighbors:

- address: 172.30.0.3

asn: 4200000000

ebgpMultiHop: true

port: 180

toAdvertise:

allowed:

prefixes:

- 192.168.2.0/24

prefixes:

- 192.168.2.0/24

- 192.169.2.0/24

# ...-

allowed.prefixes: プレフィックスのサブセットを通知します。

次の例は、すべての接頭辞をアドバタイズする方法を示しています。

FRRConfiguration CR の例

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: test

namespace: frr-k8s-system

spec:

bgp:

routers:

- asn: 64512

neighbors:

- address: 172.30.0.3

asn: 4200000000

ebgpMultiHop: true

port: 180

toAdvertise:

allowed:

mode: all

prefixes:

- 192.168.2.0/24

- 192.169.2.0/24

# ...allowed.mode: すべてのプレフィックスを通知します。toReceiveパラメーター-

デフォルトでは、

FRR-K8sは近隣によってアドバタイズされた接頭辞を処理しません。このようなアドレスを処理するには、toReceiveパラメーターを使用できます。

次の例のように、接頭辞のサブセットを設定できます。

FRRConfiguration CR の例

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: test

namespace: frr-k8s-system

spec:

bgp:

routers:

- asn: 64512

neighbors:

- address: 172.18.0.5

asn: 64512

port: 179

toReceive:

allowed:

prefixes:

- prefix: 192.168.1.0/24

- prefix: 192.169.2.0/24

ge: 25

le: 28

# ...-

接頭辞: 接頭辞の長さがle接頭辞の長さ以下で、ge接頭辞の長さ以上の場合、接頭辞が適用されます。

次の例では、アナウンスされたすべての接頭辞を処理するように FRR を設定します。

FRRConfiguration CR の例

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: test

namespace: frr-k8s-system

spec:

bgp:

routers:

- asn: 64512

neighbors:

- address: 172.18.0.5

asn: 64512

port: 179

toReceive:

allowed:

mode: all

# ...bgpパラメーター-

bgpパラメーターを使用すると、さまざまなBFDプロファイルを定義し、それらをネイバーに関連付けることができます。次の例では、BFDは、BGPセッションをバックアップし、FRRはリンク障害を検出できます。

FRRConfiguration CR の例

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: test

namespace: frr-k8s-system

spec:

bgp:

routers:

- asn: 64512

neighbors:

- address: 172.30.0.3

asn: 64512

port: 180

bfdProfile: defaultprofile

bfdProfiles:

- name: defaultprofile

# ...nodeSelectorパラメーター-

デフォルトでは、

FRR-K8sは、デーモンが実行されているすべてのノードに設定を適用します。nodeSelectorパラメーターを使用すると、設定を適用するノードを指定できます。以下に例を示します。

FRRConfiguration CR の例

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: test

namespace: frr-k8s-system

spec:

bgp:

routers:

- asn: 64512

nodeSelector:

labelSelector:

foo: "bar"

# ...インターフェイスパラメーター-

インターフェイスパラメーターを使用すると、以下の設定例のように、番号なし BGP ピアリングを設定できます。

FRRConfiguration CR の例

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: test

namespace: frr-k8s-system

spec:

bgp:

bfdProfiles:

- echoMode: false

name: simple

passiveMode: false

routers:

- asn: 64512

neighbors:

- asn: 64512

bfdProfile: simple

disableMP: false

interface: net10

port: 179

toAdvertise:

allowed:

mode: filtered

prefixes:

- 5.5.5.5/32

toReceive:

allowed:

mode: filtered

prefixes:

- 5.5.5.5/32

# ...-

neighbors.interface: 番号なしの BGP ピアリングを有効にします。

インターフェイス パラメーターを使用するには、2 つの BGP ピア間でポイントツーポイントのレイヤ 2 接続を確立する必要があります。番号なし BGP ピアリングは、IPv4、IPv6、またはデュアルスタックで使用できますが、IPv6 RA (ルーターアドバタイズメント) を有効にする必要があります。各インターフェイスは 1 つの BGP 接続に制限されます。

このパラメーターを使用する場合、spec.bgp.routers.neighbors.address パラメーターに値を指定することはできません。

FRRConfiguration カスタムリソースのパラメーターは、次の表に記載されています。

| パラメーター | 型 | 説明 |

|---|---|---|

|

|

| FRR が設定するルーターを指定します (VRF ごとに 1 つ)。 |

|

|

| セッションのローカル側で使用する AS 番号 (ASN)。 |

|

|

|

|

|

|

| このルーターからセッションを確立するために使用するホスト VRF を指定します。 |

|

|

| BGP セッションを確立する近隣を指定します。 |

|

|

|

セッションのリモート終了に使用する ASN を指定します。このパラメーターを使用する場合、 |

|

|

|

明示的に設定せずに、セッションのリモートエンドに使用する ASN を検出します。同じ ASN を持つネイバーの場合は |

|

|

|

セッションを確立する IP アドレスを指定します。このパラメーターを使用する場合、 |

|

|

| セッションを確立するときに使用するインターフェイス名を指定します。このパラメーターを使用して、番号なし BGP ピアリングを設定します。2 つの BGP ピア間には、ポイントツーポイントのレイヤー 2 接続が必要です。番号なし BGP ピアリングは、IPv4、IPv6、またはデュアルスタックで使用できますが、IPv6 RA (ルーターアドバタイズメント) を有効にする必要があります。各インターフェイスは 1 つの BGP 接続に制限されます。 |

|

|

|

セッションを確立するときにダイアリングするポートを指定します。デフォルト値は |

|

|

|

BGP セッションの確立に使用するパスワードを指定します。 |

|

|

|

ネイバーの認証シークレットの名前を指定します。シークレットは "kubernetes.io/basic-auth" タイプであり、FRR-K8s デーモンと同じ namespace にある必要があります。キー "password" はパスワードをシークレットに保存します。 |

|

|

| RFC4271 に従って、要求された BGP ホールド時間を指定します。デフォルトは 180s です。 |

|

|

|

RFC4271 に従って、要求された BGP キープアライブ時間を指定します。デフォルトは |

|

|

| BGP が近隣に次に接続を試行するまで待機する時間を指定します。 |

|

|

| BGP ピアが複数ホップ離れているかどうかを示します。 |

|

|

| BGP セッションに関連付けられた BFD セッションに使用する BFD プロファイルの名前を指定します。設定されていない場合、BFD セッションは設定されません。 |

|

|

| 近隣にアドバタイズする接頭辞のリストと、関連するプロパティーを表します。 |

|

|

| 近隣にアドバタイズする接頭辞のリストを指定します。このリストは、ルーターで定義した接頭辞と一致する必要があります。 |

|

|

|

接頭辞を処理するときに使用するモードを指定します。接頭辞リスト内の接頭辞のみを許可するように |

|

|

| アドバタイズされたローカルプリファレンスに関連付けられた接頭辞を指定します。ローカル設定に関連付けられた接頭辞を、アドバタイズが許可される接頭辞に指定する必要があります。 |

|

|

| ローカル設定に関連付けられた接頭辞を指定します。 |

|

|

| 接頭辞に関連付けられたローカル設定を指定します。 |

|

|

| アドバタイズされた BGP コミュニティーに関連付けられた接頭辞を指定します。アドバタイズする接頭辞のリストに、ローカル設定に関連付けられた接頭辞を含める必要があります。 |

|

|

| コミュニティーに関連付けられた接頭辞を指定します。 |

|

|

| 接頭辞に関連付けられたコミュニティーを指定します。 |

|

|

| 近隣から受信する接頭辞を指定します。 |

|

|

| 近隣から受信する情報を指定します。 |

|

|

| 近隣から許可される接頭辞を指定します。 |

|

|

|

接頭辞を処理するときに使用するモードを指定します。 |

|

|

| MP BGP を無効にして、IPv4 と IPv6 のルート交換を別々の BGP セッションに分離しないようにします。 |

|

|

| このルーターインスタンスからアドバタイズするすべての接頭辞を指定します。 |

|

|

| ネイバーを設定する際に使用する BFD プロファイルのリストを指定します。 |

|

|

| 設定の他の部分で参照される BFD プロファイルの名前。 |

|

|

|

このシステムが制御パケットを受信できる最小間隔をミリ秒単位で指定します。デフォルトは |

|

|

|

このシステムが BFD 制御パケットを送信するために使用する、ジッターを除いた最小送信間隔をミリ秒単位で指定します。デフォルトは |

|

|

| パケット損失を判定するための検出乗数を設定します。接続損失検出タイマーを決定するには、リモート送信間隔にこの値を乗算します。 |

|

|

|

このシステムが処理できる最小のエコー受信送信間隔をミリ秒単位で設定します。デフォルトは |

|

|

| エコー送信モードを有効または無効にします。このモードはデフォルトで無効になっており、マルチホップ設定ではサポートされていません。 |

|

|

| セッションを passive としてマークします。passive セッションでは接続を開始せず、応答を開始する前にピアからの制御パケットを待機します。 |

|

|

| マルチホップセッションのみ。着信 BFD 制御パケットの最小予想 TTL を設定します。 |

|

|

| この設定の適用を試みるノードを制限します。指定した場合、指定されたセレクターに一致するラベルが割り当てられたノードのみが設定の適用を試みます。指定されていない場合は、すべてのノードがこの設定を適用しようとします。 |

|

|

| FRRConfiguration の監視状態を定義します。 |

6.2. BGP ルーティングの有効化

クラスター管理者は、クラスターに対して OVN-Kubernetes Border Gateway Protocol (BGP) ルーティングサポートを有効にできます。

6.2.1. Border Gateway Protocol (BGP) ルーティングの有効化

クラスター管理者は、ベアメタルインフラストラクチャー上のクラスターに対して Border Gateway Protocol (BGP) ルーティングサポートを有効にできます。

MetalLB Operator と組み合わせて BGP ルーティングを使用している場合は、必要な BGP ルーティングサポートが自動的に有効になります。BGP ルーティングサポートを手動で有効にする必要はありません。

6.2.1.1. BGP ルーティングサポートの有効化

クラスター管理者は、クラスターに対して BGP ルーティングサポートを有効にできます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-adminロールを持つユーザーとしてクラスターにログインしている。 - クラスターは、互換性のあるインフラストラクチャーにインストールされている。

手順

次のコマンドを入力して、動的ルーティングプロバイダーを有効にします。

$ oc patch Network.operator.openshift.io/cluster --type=merge -p '{ "spec": { "additionalRoutingCapabilities": { "providers": ["FRR"] } } }'

6.3. BGP ルーティングの無効化

クラスター管理者は、クラスターに対して OVN-Kubernetes Border Gateway Protocol (BGP) ルーティングサポートを有効にできます。

6.3.1. Border Gateway Protocol (BGP) ルーティングの無効化

クラスター管理者は、ベアメタルインフラストラクチャー上のクラスターに対して Border Gateway Protocol (BGP) ルーティングサポートを無効にできます。

6.3.1.1. BGP ルーティングサポートを無効にする

クラスター管理者は、クラスターに対して BGP ルーティングサポートを無効にできます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-adminロールを持つユーザーとしてクラスターにログインしている。 - クラスターは、互換性のあるインフラストラクチャーにインストールされている。

手順

次のコマンドを入力して、動的ルーティングを無効にします。

$ oc patch Network.operator.openshift.io/cluster --type=merge -p '{ "spec": { "additionalRoutingCapabilities": null } }'

6.4. FRR-K8s リソースの移行

OpenShift Container Platform 4.17 以前のリリースの metallb-system namespace にある、ユーザーが作成したすべての FRR-K8s カスタムリソース (CR) は、openshift-frr-k8s namespace に移行する必要があります。クラスター管理者は、この手順のステップを完了して FRR-K8s カスタムリソースを移行します。

6.4.1. FRR-K8s リソースの移行

FRR-K8s FRRConfiguration カスタムリソースを、metallb-system namespace から openshift-frr-k8s namespace に移行できます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-adminロールを持つユーザーとしてクラスターにログインしている。

手順

Metal LB Operator がデプロイされた OpenShift Container Platform の以前のバージョンからアップグレードする場合は、カスタム FRRConfiguration 設定を metallb-system namespace から openshift-frr-k8s namespace に手動で移行する必要があります。これらの CR を移動するには、次のコマンドを入力します。

openshift-frr-k8snamespace を作成するには、次のコマンドを入力します。$ oc create namespace openshift-frr-k8s移行を自動化するには、次の内容のシェルスクリプトを

migrate.shという名前で作成します。#!/bin/bash OLD_NAMESPACE="metallb-system" NEW_NAMESPACE="openshift-frr-k8s" FILTER_OUT="metallb-" oc get frrconfigurations.frrk8s.metallb.io -n "${OLD_NAMESPACE}" -o json |\ jq -r '.items[] | select(.metadata.name | test("'"${FILTER_OUT}"'") | not)' |\ jq -r '.metadata.namespace = "'"${NEW_NAMESPACE}"'"' |\ oc create -f -移行を実行するには、次のコマンドを実行します。

$ bash migrate.sh

検証

次のコマンドを実行して、移行が成功したことを確認します。

$ oc get frrconfigurations.frrk8s.metallb.io -n openshift-frr-k8s

移行が完了すると、metallb-system namespace から FRRConfiguration カスタムリソースを削除できます。

第7章 ルートアドバタイズメント

7.1. ルートアドバタイズメントについて

ネットワーク管理を簡素化し、フェイルオーバーの可視性を向上させるために、ルートアドバタイズメントを使用して、クラスターとプロバイダーネットワーク間で Pod および EgressIP ルートを共有できます。この機能を使用するには、OVN-Kubernetes プラグインと BGP(Border Gateway Protocol) プロバイダーが必要です。

詳細は、BGP ルーティングについて を参照してください。

7.1.1. Border Gateway Protocol を使用したクラスターネットワークルートのアドバタイズ

ルーティングを簡素化し、手動でのルート管理なしにフェイルオーバーの可視性を向上させるには、ルートアドバタイズメントを有効にすることができます。ルートアドバタイズメントを使用すると、クラスターとプロバイダーネットワーク間のデフォルトルートおよびユーザー定義のネットワークルート (EgressIP を含む) をアドバタイズできます。

ルートアドバタイズメントを有効にすると、デフォルトの Pod ネットワークおよびユーザー定義ネットワークのネットワークルートをプロバイダーネットワークにアドバタイズできます (EgressIP を含む)。また、プロバイダーネットワークからデフォルトの Pod ネットワークおよび CUDN にルートをインポートすることもできます。これにより、ルーティングが簡素化されるとともに、フェイルオーバー時の可視性が向上し、手動によるルート管理が不要になります。

プロバイダーネットワークからは、デフォルトの Pod ネットワークおよびユーザー定義ネットワークからアドバタイズされた IP アドレスに直接アクセスでき、その逆も同様です。

たとえば、デフォルトの Pod ネットワークにルートをインポートできるため、各ノードでルートを手動で設定する必要がなくなります。以前は、routingViaHost パラメーターを true に設定し、同様の設定に近づけるために各ノードでルートを手動で設定していた可能性があります。ルートアドバタイズメントを使用すると、routingViaHost パラメーターを false に設定することで、このタスクをシームレスに実行できます。

クラスターの Network カスタムリソース CR で routingViaHost パラメーターを true に設定することもできますが、その場合は同様の設定をシミュレートするために各ノードでルートを手動で設定する必要があります。ルートアドバタイズを有効にすると、ノードごとにルートを手動で設定しなくても、Network CR で routingViaHost=false を設定できます。

プロバイダーネットワーク上のルートリフレクタがサポートされており、大規模ネットワーク上でルートをアドバタイズするために必要な BGP 接続の数を削減できます。

ルートアドバタイズメントを有効にして EgressIP を使用する場合、レイヤー 3 プロバイダーネットワークは EgressIP フェイルオーバーを認識します。つまり、これまではレイヤー 2 プロバイダーネットワークのみが認識していたため、すべての Egress ノードが同じレイヤー 2 セグメント上にある必要がありましたが、異なるレイヤー 2 セグメント上に EgressIP をホストするクラスターノードを配置できるようになります。

7.1.1.1. サポートされているプラットフォーム

ベアメタルインフラストラクチャータイプでは、Border Gateway Protocol (BGP) を使用したルートアドバタイズメントがサポートされています。

7.1.1.2. インフラストラクチャーの要件

ルートアドバタイズメントを使用するには、ネットワークインフラストラクチャーに BGP を設定する必要があります。ネットワークインフラストラクチャーの停止や設定ミスにより、クラスターネットワークが中断される可能性があります。

7.1.1.3. 他のネットワーク機能との互換性

ルートアドバタイズメントは、次の OpenShift Container Platform ネットワーク機能をサポートします。

- 複数の外部ゲートウェイ (MEG)

- この機能で MEG はサポートされていません。

- EgressIP

EgressIP の使用とアドバタイズメントがサポートされます。Egress IP アドレスが存在するノードは、EgressIP をアドバタイズします。Egress IP アドレスは、Egress ノードと同じレイヤー 2 ネットワークサブネット上にある必要があります。以下の制限が適用されます。

- レイヤー 2 モードで動作するユーザー定義ネットワーク (CUDN) からの EgressIP のアドバタイズメントはサポートされていません。

- プライマリーネットワークインターフェイスに割り当てられた Egress IP アドレスと、追加のネットワークインターフェイスに割り当てられた Egress IP アドレスの両方を持つネットワークの EgressIP をアドバタイズすることは現実的ではありません。すべての EgressIP は、選択された FRRConfiguration インスタンスのすべての BGP セッションでアドバタイズされます。これは、セッションが EgressIP が割り当てられている同じインターフェイス上で確立されているかどうかかかわらず実行されるため、不要なアドバタイズが発生する可能性があります。

- サービス

- MetalLB Operator と連携して、プロバイダーネットワークにサービスをアドバタイズします。

- Egress サービス

- 完全サポート

- Egress ファイアウォール

- 完全サポート

- Egress QoS

- 完全サポート

- ネットワークポリシー

- 完全サポート

- Pod の直接 Ingress

- デフォルトのクラスターネットワークとクラスターユーザー定義 (CUDN) ネットワークを完全にサポートします。

7.1.1.4. MetalLB Operator の使用に関する考慮事項

MetalLB Operator は、クラスターへのアドオンとしてインストールされます。MetalLB Operator をデプロイすると、、追加のルーティング機能プロバイダーとして FRR-K8 が自動的に有効になります。この機能と MetalLB Operator は、同じ FRR-K8s デプロイメントを使用します。

7.1.1.5. クラスターユーザー定義ネットワーク (CUDN) の命名に関する考慮事項

FRRConfiguration CR で VRF デバイスを参照する場合、VRF 名は 15 文字以下の VRF 名の CUDN 名と同じになります。CUDN 名から VRF 名を推測できるように、15 文字以下の VRF 名を使用することが推奨されます。

7.1.1.6. BGP ルーティングカスタムリソース

次のカスタムリソース (CR) は、BGP によるルートアドバタイズメントを設定するために使用されます。

RouteAdvertisements-

この CR は、BGP ルーティングのアドバタイズメントを定義します。この CR から、OVN-Kubernetes コントローラーは、クラスターネットワークルートをアドバタイズするように FRR デーモンを設定する

FRRConfigurationオブジェクトを生成します。これは、クラスタースコープの CR です。 FRRConfiguration-

この CR は、BGP ピアを定義し、プロバイダーネットワークからクラスターネットワークへのルートインポートを設定するために使用されます。BGP ピアを設定するためには、

RouteAdvertisementsオブジェクトを適用する前に、まず少なくとも 1 つの FRRConfiguration オブジェクトを定義する必要があります。この CR には namespace があります。

7.1.1.7. OVN-Kubernetes コントローラーによる FRRConfiguration オブジェクトの生成

FRRConfiguration オブジェクトは、各ノードに適用される、アドバタイズされた適切な接頭辞を持つ RouteAdvertisements CR によって選択されたネットワークおよびノードごとに生成されます。OVN-Kubernetes コントローラーは、RouteAdvertisements CR によって選択されたノードが、RouteAdvertisements CR によって選択された FRR 設定に基づき選択されたノードのサブセットであるかどうかを確認します。

RouteAdvertisement CR から生成される FRRConfiguration オブジェクトでは、受信する接頭辞のフィルタリングや選択は考慮されません。他の FRRConfiguration オブジェクトで受信する接頭辞を設定してください。OVN-Kubernetes は、VRF から適切なネットワークにルートをインポートします。

7.1.1.8. Cluster Network Operator の設定

Cluster Network Operator (CNO) API は、ルートアドバタイズメントを設定するためのいくつかのフィールドを公開します。

-

spec.additionalRoutingCapabilities.providers: ルートをアドバタイズするために必要な追加のルーティングプロバイダーを指定します。サポートされている値はFRRのみで、これによりクラスターの FRR-K8S デーモンのデプロイメントが有効になります。有効にすると、FRR-K8S デーモンがすべてのノードにデプロイされます。 -

spec.defaultNetwork.ovnKubernetesConfig.routeAdvertisements: デフォルトのクラスターネットワークと CUDN ネットワークのルートアドバタイズメントを有効にします。この機能を有効にするには、spec.additionalRoutingCapabilitiesフィールドをFRRに設定する必要があります。

7.1.2. RouteAdvertisements オブジェクトの設定

クラスターネットワークと EgressIP アドレスを外部ルーターにアドバタイズする方法を制御するには、クラスタースコープの RouteAdvertisements オブジェクトを設定してネットワークを指定し、環境に適したノードとルーティングターゲットを選択します。

次のプロパティーを使用して、クラスタースコープの RouteAdvertisements オブジェクトを定義できます。

RouteAdvertisements カスタムリソース (CR) のフィールドについては、次の表で説明しています。

| フィールド | 型 | 説明 |

|---|---|---|

|

|

|

|

|

|

|

アドバタイズする異なるタイプのネットワークを含めることができる配列を指定します。 |

|

|

|

OVN-Kubernetes ドリブンの |

|

|

| デフォルトのクラスターネットワークとクラスターユーザー定義ネットワーク (CUDN) の間でアドバタイズするネットワークを指定します。 |

|

|

|

アドバタイズメントを選択したノードに制限します。 |

|

|

|

どのルーターでルートをアドバタイズするかを決定します。ルートは、選択された |

7.1.3. BGP により Pod IP アドレスをアドバタイズする例

クラスターに Border Gateway Protocol (BGP) を実装するには、以下の例を使用して、Pod の IP アドレスと出力 IP アドレスのルートアドバタイズメントを設定できます。例としては、デフォルトのクラスターネットワーク、ユーザー定義ネットワーク、および VRF-lite 設計の設定などが挙げられます。

次の例では、Border Gateway Protocol (BGP) を使用して Pod IP アドレスと EgressIP をアドバタイズするためのいくつかの設定について説明します。外部ネットワークボーダールーターの IP アドレスは 172.18.0.5 です。これらの設定では、クラスターネットワーク上のすべてのノードにルートを中継できる外部ルートリフレクターが設定されていることを前提としています。

7.1.3.1. デフォルトのクラスターネットワークのアドバタイズ

このシナリオでは、デフォルトのクラスターネットワークが外部ネットワークに公開され、Pod の IP アドレスと EgressIP がプロバイダーネットワークにアドバタイズされます。

このシナリオは、次の FRRConfiguration オブジェクトに依存します。

FRRConfiguration CR

apiVersion: k8s.ovn.org/v1

kind: RouteAdvertisements

metadata:

name: default

spec:

advertisements:

- PodNetwork

- EgressIP

networkSelectors:

- networkSelectionType: DefaultNetwork

frrConfigurationSelector:

matchLabels:

routeAdvertisements: receive-all

nodeSelector: {}

OVN-Kubernetes コントローラーがこの RouteAdvertisements CR を認識すると、選択された FRRConfiguration オブジェクトに基づき追加のオブジェクトを生成します。生成された追加オブジェクトは、デフォルトのクラスターネットワークのルートをアドバタイズするように FRR デーモンを設定します。

OVN-Kubernetes によって生成された FRRConfiguration CR の例

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: ovnk-generated-abcdef

namespace: openshift-frr-k8s

spec:

bgp:

routers:

- asn: 64512

neighbors:

- address: 172.18.0.5

asn: 64512

toReceive:

allowed:

mode: filtered

toAdvertise:

allowed:

prefixes:

- <default_network_host_subnet>

prefixes:

- <default_network_host_subnet>

nodeSelector:

matchLabels:

kubernetes.io/hostname: ovn-worker

生成された FRRConfiguration オブジェクトの例では、<default_network_host_subnet> は、プロバイダーネットワークにアドバタイズされるデフォルトのクラスターネットワークのサブネットです。

7.1.3.2. BGP 経由でクラスターのユーザー定義ネットワークから Pod IP をアドバタイズする

このシナリオでは、blue クラスターユーザー定義ネットワーク (CUDN) が外部ネットワークに公開されるため、ネットワークの Pod IP アドレスと EgressIP がプロバイダーネットワークにアドバタイズされます。

このシナリオは、次の FRRConfiguration オブジェクトに依存します。

FRRConfiguration CR

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: receive-all

namespace: openshift-frr-k8s

labels:

routeAdvertisements: receive-all

spec:

bgp:

routers:

- asn: 64512

neighbors:

- address: 172.18.0.5

asn: 64512

disableMP: true

toReceive:

allowed:

mode: all

この FRRConfiguration オブジェクトを使用すると、ルートは近隣の 172.18.0.5 からデフォルトの VRF にインポートされ、デフォルトのクラスターネットワークで使用できるようになります。

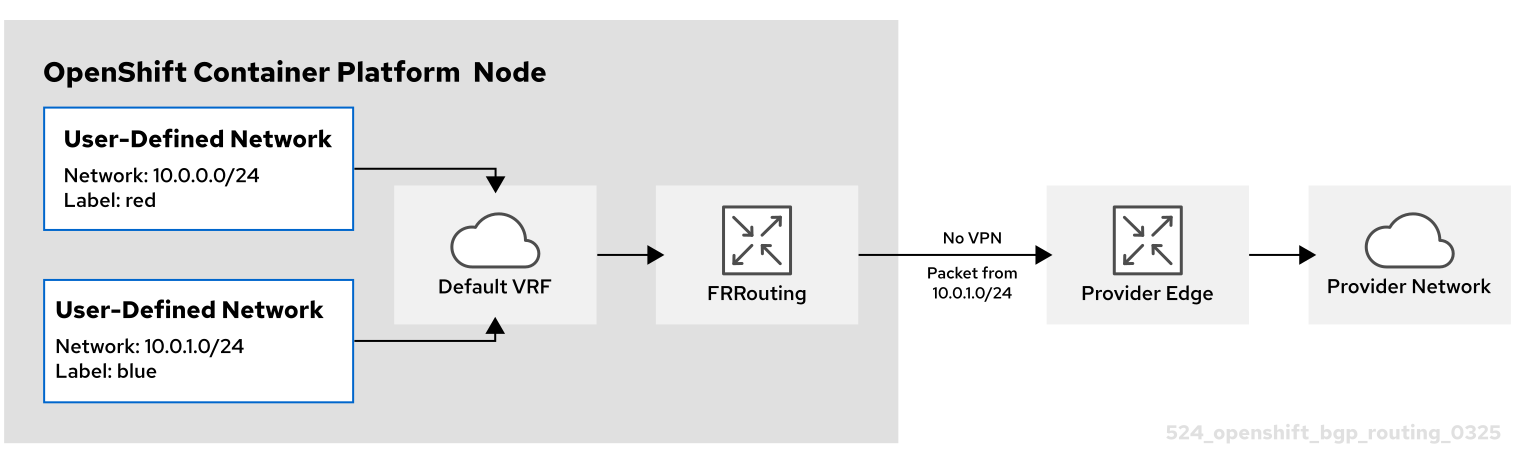

次の図に示すように、CUDN はデフォルトの VRF を介してアドバタイズされます。

- red CUDN

-

redという名前の CUDN に関連付けられているredという名前の VRF -

10.0.0.0/24のサブネット

-

- blue CUDN

-

blueという名前の CUDN に関連付けられているblueという名前の VRF -

10.0.1.0/24のサブネット

-

この設定では、2 つの異なる CUDN が定義されます。red ネットワークは 10.0.0.0/24 サブネットをカバーし、blue ネットワークは 10.0.1.0/24 サブネットをカバーします。red および blue ネットワークには、export: true というラベルが付けられています。

次の RouteAdvertisements CR は、red および blue テナントの設定について説明します。

red および blue テナントの RouteAdvertisements CR

apiVersion: k8s.ovn.org/v1

kind: RouteAdvertisements

metadata:

name: advertise-cudns

spec:

advertisements:

- PodNetwork

- EgressIP

networkSelectors:

- networkSelectionType: ClusterUserDefinedNetworks

clusterUserDefinedNetworkSelector:

networkSelector:

matchLabels:

export: "true"

frrConfigurationSelector:

matchLabels:

routeAdvertisements: receive-all

nodeSelector: {}

OVN-Kubernetes コントローラーがこの RouteAdvertisements CR を認識すると、選択された FRRConfiguration オブジェクトに基づき追加のオブジェクトを生成します。生成された追加オブジェクトは、ルートをアドバタイズするように FRR デーモンを設定します。以下は、そのような設定オブジェクトの一例であり、選択されたノードとネットワークに応じて作成される FRRConfiguration オブジェクトの数が表示されます。

OVN-Kubernetes によって生成された FRRConfiguration CR の例

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: ovnk-generated-abcdef

namespace: openshift-frr-k8s

spec:

bgp:

routers:

- asn: 64512

vrf: blue

imports:

- vrf: default

- asn: 64512

neighbors:

- address: 172.18.0.5

asn: 64512

toReceive:

allowed:

mode: filtered

toAdvertise:

allowed:

prefixes:

- 10.0.1.0/24

prefixes:

- 10.0.1.0/24

imports:

- vrf: blue

nodeSelector:

matchLabels:

kubernetes.io/hostname: ovn-worker

生成された FRRConfiguration オブジェクトは、blue ネットワークに属するサブネット 10.0.1.0/24 をデフォルトの VRF にインポートし、近隣の 172.18.0.5 にアドバタイズするように設定します。RouteAdvertisements CR によって選択された各ネットワークおよびノードに対して、各ノードに適用される適切な接頭辞を持つ FRRConfiguration オブジェクトが生成されます。

targetVRF フィールドを省略すると、ルートはデフォルトの VRF 経由でリークされ、アドバタイズされます。さらに、初期 FRRConfiguration オブジェクトの定義後にデフォルト VRF にインポートされたルートも、blue VRF にインポートされます。

7.1.3.3. クラスターユーザー定義ネットワークから BGP 経由で VPN を使用して Pod IP をアドバタイズする

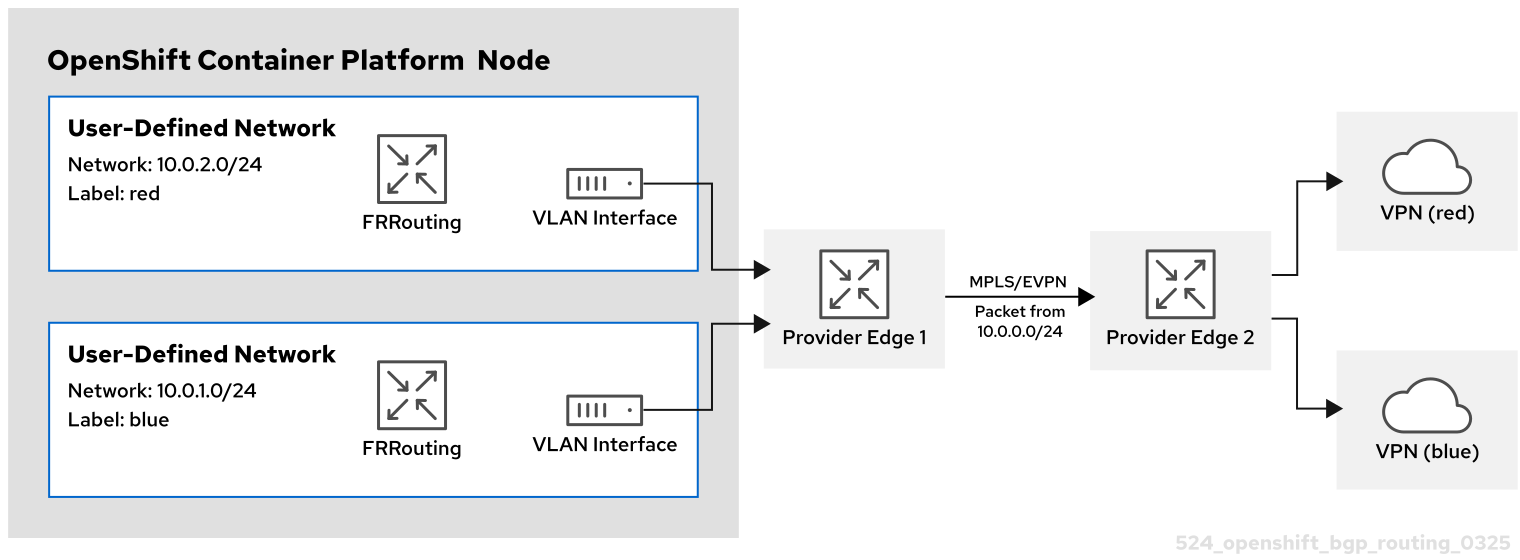

このシナリオでは、VLAN インターフェイスは、blue ネットワークに関連付けられた VRF デバイスにアタッチされます。このセットアップは VRF lite 設計を提供します。FRR-K8S は、blue ネットワーク VRF/VLAN リンク上の対応する BGP セッションを介してのみ、blue ネットワークをネクストホップの Provide Edge (PE) ルーターにアドバタイズするために使用されます。red テナントは同じ設定を使用します。blue および red ネットワークには、export: true というラベルが付けられています。

このシナリオでは、EgressIP の使用はサポートされていません。

次の図はこの設定を示しています。

- red CUDN

-

redという名前の CUDN に関連付けられているredという名前の VRF - VRF デバイスにアタッチされ、外部 PE ルーターに接続された VLAN インターフェイス

-

割り当てられたサブネット

10.0.2.0/24

-

- blue CUDN

-

blueという名前の CUDN に関連付けられているblueという名前の VRF - VRF デバイスにアタッチされ、外部 PE ルーターに接続された VLAN インターフェイス

-

割り当てられたサブネット

10.0.1.0/24

-

このアプローチは、OVN-Kubernetes ネットワークプラグインの ovnKubernetesConfig.gatewayConfig 仕様で routingViaHost=true を設定した場合にのみ使用できます。

次の設定では、追加の FRRConfiguration CR によって、blue および red の VLAN 上の PE ルーターとのピアリングが設定されます。

FRRConfiguration CR を BGP VPN セットアップ用に手動で設定しました

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: vpn-blue-red

namespace: openshift-frr-k8s

labels:

routeAdvertisements: vpn-blue-red

spec:

bgp:

routers:

- asn: 64512

vrf: blue

neighbors:

- address: 182.18.0.5

asn: 64512

toReceive:

allowed:

mode: filtered

- asn: 64512

vrf: red

neighbors:

- address: 192.18.0.5

asn: 64512

toReceive:

allowed:

mode: filtered

次の RouteAdvertisements CR は、blue および red テナントの設定を記述しています。

blue および red テナントの RouteAdvertisements CR

apiVersion: k8s.ovn.org/v1

kind: RouteAdvertisements

metadata:

name: advertise-vrf-lite

spec:

targetVRF: auto

advertisements:

- "PodNetwork"

nodeSelector: {}

frrConfigurationSelector:

matchLabels:

routeAdvertisements: vpn-blue-red

networkSelectors:

- networkSelectionType: ClusterUserDefinedNetworks

clusterUserDefinedNetworkSelector:

networkSelector:

matchLabels:

export: "true"

RouteAdvertisements CR では、選択された個々のネットワークに対応する VRF デバイス内でアドバタイズメントが行われるように、targetVRF が auto に設定されています。このシナリオでは、blue の Pod サブネットは blue VRF デバイス経由でアドバタイズされ、red の Pod サブネットは red VRF デバイス経由でアドバタイズされます。さらに、各 BGP セッションは、初期 FRRConfiguration オブジェクトで定義されているとおり、対応する CUDN VRF にのみルートをインポートします。

OVN-Kubernetes コントローラーがこの RouteAdvertisements CR を認識すると、選択された FRRConfiguration オブジェクトに基づき追加のオブジェクトを生成します。生成された追加オブジェクトは、blue および red テナントのルートをアドバタイズするように FRR デーモンを設定します。

OVN-Kubernetes によって生成された blue および red テナント用の FRRConfiguration CR の例

apiVersion: frrk8s.metallb.io/v1beta1

kind: FRRConfiguration

metadata:

name: ovnk-generated-abcde

namespace: openshift-frr-k8s

spec:

bgp:

routers:

- asn: 64512

neighbors:

- address: 182.18.0.5

asn: 64512

toReceive:

allowed:

mode: filtered

toAdvertise:

allowed:

prefixes:

- 10.0.1.0/24

vrf: blue

prefixes:

- 10.0.1.0/24

- asn: 64512

neighbors:

- address: 192.18.0.5

asn: 64512

toReceive:

allowed:

mode: filtered

toAdvertise:

allowed:

prefixes:

- 10.0.2.0/24

vrf: red

prefixes:

- 10.0.2.0/24

nodeSelector:

matchLabels:

kubernetes.io/hostname: ovn-worker

このシナリオでは、受信するルートのフィルタリングまたは選択は、ピアリング関係を定義する FRRConfiguration CR で行う必要があります。

7.2. ルートアドバタイズメントの有効化

クラスターのネットワーク到達性とフェイルオーバーの可視性を向上させるには、Pod および出力 IP アドレスのルートアドバタイズメントを有効にすることができます。この設定には OVN-Kubernetes ネットワークプラグインが必要で、クラスターが外部プロバイダーネットワークとルートを共有できるようになります。

クラスター管理者は、クラスターの追加のルートアドバタイズメントを設定できます。OVN-Kubernetes ネットワークプラグインを使用する必要があります。

7.2.1. ルートアドバタイズメントの有効化

ネットワークの到達性とフェイルオーバーの可視性を向上させるために、クラスターに追加のルーティングサポートを有効にすることができます。ルートアドバタイズメントを有効にすることで、環境内のネットワークトラフィックを管理できます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-adminロールを持つユーザーとしてクラスターにログインしている。 - クラスターは、互換性のあるインフラストラクチャーにインストールされている。

手順

次のコマンドを入力して、ルーティングプロバイダーと追加のルートアドバタイズメントを有効にします。

$ oc patch Network.operator.openshift.io cluster --type=merge \ -p='{ "spec": { "additionalRoutingCapabilities": { "providers": ["FRR"] }, "defaultNetwork": { "ovnKubernetesConfig": { "routeAdvertisements": "Enabled" }}}}'

7.3. ルートアドバタイズメントの無効化

プロバイダーネットワークへのクラスターネットワークルートと EgressIP アドレスのブロードキャストを停止するには、ルートアドバタイズメントを無効にできます。この機能を無効にすると、既存のネットワークインフラストラクチャーを維持したまま、自動生成されたルーティング設定が削除されます。

7.3.1. ルートアドバタイズメントの無効化

クラスターがネットワークに追加のルートをアドバタイズしないようにするには、ネットワークオペレーターの設定でルートアドバタイズ機能を無効にする必要があります。ルーティング広告を無効にすることで、ネットワークトラフィックを管理し、環境内のセキュリティーを維持できます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-adminロールを持つユーザーとしてクラスターにログインしている。 - クラスターは、互換性のあるインフラストラクチャーにインストールされている。

手順

次のコマンドを入力して、追加のルーティングサポートを無効にします。

$ oc patch network.operator cluster -p '{ "spec": { "defaultNetwork": { "ovnKubernetesConfig": { "routeAdvertisements": "Disabled" } } } }'

7.4. ルートアドバタイズメントのセットアップ例

ベアメタルインフラストラクチャー上でルートリフレクションの設定を実装する方法を学ぶには、このサンプル設定を参照してください。この例では、必要なフィーチャーゲートを有効にし、オブジェクトを設定して Pod と送信側の IP ルートをアドバタイズする方法を示します。

クラスター管理者は、クラスターに対して次のルートアドバタイズメントのセットアップ例を設定できます。この設定は、ルートアドバタイズメントの設定方法を示すサンプルとして使用しています。

7.4.1. ルートアドバタイズメントのセットアップ例

サンプル設定を使用してクラスターのルートアドバタイズメントを設定することで、BGP(Border Gateway Protocol) ルーティングを実装できます。この設定は、ベアメタルインフラストラクチャー上でルートリフレクションを設定して、Pod と送信側の IP ルートを共有する方法を示しています。

クラスター管理者は、クラスターに対して Border Gateway Protocol (BGP) ルーティングサポートを有効にできます。この設定では、フルメッシュセットアップではなくルートリフレクションを使用します。

BGP ルーティングは、ベアメタルインフラストラクチャーでのみサポートされます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-admin権限を持つユーザーとしてクラスターにログインしている。 - クラスターは、ベアメタルインフラストラクチャーにインストールされている。

- FRR デーモンコンテナーを実行する予定のクラスターにアクセスできるベアメタルシステムがある。

手順

次のコマンドを実行して、

RouteAdvertisementsフィーチャーゲートが有効になっていることを確認します。$ oc get featuregate -oyaml | grep -i routeadvertisement出力例

- name: RouteAdvertisements次のコマンドを実行して、Cluster Network Operator (CNO) を設定します。

$ oc patch Network.operator.openshift.io cluster --type=merge \ -p=' {"spec":{ "additionalRoutingCapabilities": { "providers": ["FRR"]}, "defaultNetwork":{"ovnKubernetesConfig"{ "routeAdvertisements":"Enabled" }}}}'CNO がすべてのノードを再起動するために数分かかる場合があります。

次のコマンドを実行して、ノードの IP アドレスを取得します。

$ oc get node -owide出力例

NAME STATUS ROLES AGE VERSION INTERNAL-IP EXTERNAL-IP OS-IMAGE KERNEL-VERSION CONTAINER-RUNTIME master-0 Ready control-plane,master 27h v1.31.3 192.168.111.20 <none> Red Hat Enterprise Linux CoreOS 418.94.202501062026-0 5.14.0-427.50.1.el9_4.x86_64 cri-o://1.31.4-2.rhaos4.18.git33d7598.el9 master-1 Ready control-plane,master 27h v1.31.3 192.168.111.21 <none> Red Hat Enterprise Linux CoreOS 418.94.202501062026-0 5.14.0-427.50.1.el9_4.x86_64 cri-o://1.31.4-2.rhaos4.18.git33d7598.el9 master-2 Ready control-plane,master 27h v1.31.3 192.168.111.22 <none> Red Hat Enterprise Linux CoreOS 418.94.202501062026-0 5.14.0-427.50.1.el9_4.x86_64 cri-o://1.31.4-2.rhaos4.18.git33d7598.el9 worker-0 Ready worker 27h v1.31.3 192.168.111.23 <none> Red Hat Enterprise Linux CoreOS 418.94.202501062026-0 5.14.0-427.50.1.el9_4.x86_64 cri-o://1.31.4-2.rhaos4.18.git33d7598.el9 worker-1 Ready worker 27h v1.31.3 192.168.111.24 <none> Red Hat Enterprise Linux CoreOS 418.94.202501062026-0 5.14.0-427.50.1.el9_4.x86_64 cri-o://1.31.4-2.rhaos4.18.git33d7598.el9 worker-2 Ready worker 27h v1.31.3 192.168.111.25 <none> Red Hat Enterprise Linux CoreOS 418.94.202501062026-0 5.14.0-427.50.1.el9_4.x86_64 cri-o://1.31.4-2.rhaos4.18.git33d7598.el9次のコマンドを実行して、各ノードのデフォルトの Pod ネットワークを取得します。

$ oc get node <node_name> -o=jsonpath={.metadata.annotations.k8s\\.ovn\\.org/node-subnets}出力例

{"default":["10.129.0.0/23"],"ns1.udn-network-primary-layer3":["10.150.6.0/24"]}次のコマンドを実行して、ベアメタルハイパーバイザーで、使用する外部 FRR コンテナーの IP アドレスを取得します。

$ ip -j -d route get <a cluster node's IP> | jq -r '.[] | .dev' | xargs ip -d -j address show | jq -r '.[] | .addr_info[0].local'次の例に示すように、各ノードの IP アドレスが含まれる FRR 用の

frr.confファイルを作成します。frr.conf設定ファイルの例router bgp 64512 no bgp default ipv4-unicast no bgp default ipv6-unicast no bgp network import-check neighbor 192.168.111.20 remote-as 64512 neighbor 192.168.111.20 route-reflector-client neighbor 192.168.111.21 remote-as 64512 neighbor 192.168.111.21 route-reflector-client neighbor 192.168.111.22 remote-as 64512 neighbor 192.168.111.22 route-reflector-client neighbor 192.168.111.40 remote-as 64512 neighbor 192.168.111.40 route-reflector-client neighbor 192.168.111.47 remote-as 64512 neighbor 192.168.111.47 route-reflector-client neighbor 192.168.111.23 remote-as 64512 neighbor 192.168.111.23 route-reflector-client neighbor 192.168.111.24 remote-as 64512 neighbor 192.168.111.24 route-reflector-client neighbor 192.168.111.25 remote-as 64512 neighbor 192.168.111.25 route-reflector-client address-family ipv4 unicast network 192.168.1.0/24 network 192.169.1.1/32 exit-address-family address-family ipv4 unicast neighbor 192.168.111.20 activate neighbor 192.168.111.20 next-hop-self neighbor 192.168.111.21 activate neighbor 192.168.111.21 next-hop-self neighbor 192.168.111.22 activate neighbor 192.168.111.22 next-hop-self neighbor 192.168.111.40 activate neighbor 192.168.111.40 next-hop-self neighbor 192.168.111.47 activate neighbor 192.168.111.47 next-hop-self neighbor 192.168.111.23 activate neighbor 192.168.111.23 next-hop-self neighbor 192.168.111.24 activate neighbor 192.168.111.24 next-hop-self neighbor 192.168.111.25 activate neighbor 192.168.111.25 next-hop-self exit-address-family neighbor remote-as 64512 neighbor route-reflector-client address-family ipv6 unicast network 2001:db8::/128 exit-address-family address-family ipv6 unicast neighbor activate neighbor next-hop-self exit-address-family次の内容が含まれるファイルを、

daemonsという名前で作成します。daemons設定ファイルの例# This file tells the frr package which daemons to start. # # Sample configurations for these daemons can be found in # /usr/share/doc/frr/examples/. # # ATTENTION: # # When activating a daemon for the first time, a config file, even if it is # empty, has to be present *and* be owned by the user and group "frr", else # the daemon will not be started by /etc/init.d/frr. The permissions should # be u=rw,g=r,o=. # When using "vtysh" such a config file is also needed. It should be owned by # group "frrvty" and set to ug=rw,o= though. Check /etc/pam.d/frr, too. # # The watchfrr and zebra daemons are always started. # bgpd=yes ospfd=no ospf6d=no ripd=no ripngd=no isisd=no pimd=no ldpd=no nhrpd=no eigrpd=no babeld=no sharpd=no pbrd=no bfdd=yes fabricd=no vrrpd=no # # If this option is set the /etc/init.d/frr script automatically loads # the config via "vtysh -b" when the servers are started. # Check /etc/pam.d/frr if you intend to use "vtysh"! # vtysh_enable=yes zebra_options=" -A 127.0.0.1 -s 90000000" bgpd_options=" -A 127.0.0.1" ospfd_options=" -A 127.0.0.1" ospf6d_options=" -A ::1" ripd_options=" -A 127.0.0.1" ripngd_options=" -A ::1" isisd_options=" -A 127.0.0.1" pimd_options=" -A 127.0.0.1" ldpd_options=" -A 127.0.0.1" nhrpd_options=" -A 127.0.0.1" eigrpd_options=" -A 127.0.0.1" babeld_options=" -A 127.0.0.1" sharpd_options=" -A 127.0.0.1" pbrd_options=" -A 127.0.0.1" staticd_options="-A 127.0.0.1" bfdd_options=" -A 127.0.0.1" fabricd_options="-A 127.0.0.1" vrrpd_options=" -A 127.0.0.1" # configuration profile # #frr_profile="traditional" #frr_profile="datacenter" # # This is the maximum number of FD's that will be available. # Upon startup this is read by the control files and ulimit # is called. Uncomment and use a reasonable value for your # setup if you are expecting a large number of peers in # say BGP. #MAX_FDS=1024 # The list of daemons to watch is automatically generated by the init script. #watchfrr_options="" # for debugging purposes, you can specify a "wrap" command to start instead # of starting the daemon directly, e.g. to use valgrind on ospfd: # ospfd_wrap="/usr/bin/valgrind" # or you can use "all_wrap" for all daemons, e.g. to use perf record: # all_wrap="/usr/bin/perf record --call-graph -" # the normal daemon command is added to this at the end.-

frr.confファイルとdaemonsファイルの両方を、同じディレクトリー (例:/tmp/frr) に保存します。 次のコマンドを実行して、外部 FRR コンテナーを作成します。

$ sudo podman run -d --privileged --network host --rm --ulimit core=-1 --name frr --volume /tmp/frr:/etc/frr quay.io/frrouting/frr:9.1.0次の

FRRConfiguration設定およびRouteAdvertisements設定を作成します。次の内容で

receive_all.yamlファイルを作成します。receive_all.yaml設定ファイルの例apiVersion: frrk8s.metallb.io/v1beta1 kind: FRRConfiguration metadata: name: receive-all namespace: openshift-frr-k8s spec: bgp: routers: - asn: 64512 neighbors: - address: 192.168.111.1 asn: 64512 toReceive: allowed: mode: all次の内容で

ra.yamlファイルを作成します。ra.yaml設定ファイルの例apiVersion: k8s.ovn.org/v1 kind: RouteAdvertisements metadata: name: default spec: nodeSelector: {} frrConfigurationSelector: {} networkSelectors: - networkSelectionType: DefaultNetwork advertisements: - "PodNetwork" - "EgressIP"

次のコマンドを実行して、

receive_all.yamlファイルとra.yamlファイルを適用します。$ for f in receive_all.yaml ra.yaml; do oc apply -f $f; done

検証

設定が適用されたか検証します。

次のコマンドを実行して、

FRRConfiguration設定が作成されたか検証します。$ oc get frrconfiguration -A出力例