Operator

OpenShift Container Platform での Operator の使用

概要

第1章 Operator について

概念的に、Operator は人間の運用上のナレッジを使用し、これをコンシューマーと簡単に共有できるソフトウェアにエンコードします。

Operator は、ソフトウェアの他の部分を実行する運用上の複雑さを軽減するソフトウェアの特定の部分で構成されます。Operator はソフトウェアベンダーのエンジニアリングチームの拡張機能のように動作し、(OpenShift Container Platform などの) Kubernetes 環境を監視し、その最新状態に基づいてリアルタイムの意思決定を行います。高度な Operator はアップグレードをシームレスに実行し、障害に自動的に対応するように設計されており、時間の節約のためにソフトウェアのバックアッププロセスを省略するなどのショートカットを実行することはありません。

技術的には、Operator は Kubernetes アプリケーションをパッケージ化し、デプロイし、管理する方法です。

Kubernetes アプリケーションは、Kubernetes にデプロイされ、Kubernetes API および kubectl または oc ツールを使用して管理されるアプリケーションです。Kubernetes を最大限に活用するには、Kubernetes 上で実行されるアプリケーションを提供し、管理するために拡張できるように一連の総合的な API が必要です。Operator は、Kubernetes 上でこのタイプのアプリケーションを管理するランタイムと見なすことができます。

1.1. Operator を使用する理由

Operator は以下を提供します。

- インストールおよびアップグレードの反復性。

- すべてのシステムコンポーネントの継続的なヘルスチェック。

- OpenShift コンポーネントおよび ISV コンテンツの OTA (Over-the-air) 更新。

- フィールドエンジニアからの知識をカプセル化し、1 または 2 ユーザーだけでなく、すべてのユーザーに展開する場所。

- Kubernetes にデプロイする理由

- Kubernetes (延長線上で考えると OpenShift Container Platform も含まれる) には、シークレットの処理、負荷分散、サービスの検出、自動スケーリングなどの、オンプレミスおよびクラウドプロバイダーで機能する、複雑な分散システムをビルドするために必要なすべてのプリミティブが含まれます。

- アプリケーションを Kubernetes API および

kubectlツールで管理する理由 -

これらの API は機能的に充実しており、すべてのプラットフォームのクライアントを持ち、クラスターのアクセス制御/監査機能にプラグインします。Operator は Kubernetes の拡張メカニズム、カスタムリソース定義 (CRD、Custom Resource Definition ) を使用するので、

MongoDBなどのカスタムオブジェクトはビルトインされた、ネイティブ Kubernetes オブジェクトのように表示され、機能します。 - Operator とサービスブローカーとの比較

- サービスブローカーは、アプリケーションのプログラムによる検出およびデプロイメントを行うための 1 つの手段です。ただし、これは長期的に実行されるプロセスではないため、アップグレード、フェイルオーバー、またはスケーリングなどの Day 2 オペレーションを実行できません。カスタマイズおよびチューニング可能なパラメーターはインストール時に提供されるのに対し、Operator はクラスターの最新の状態を常に監視します。クラスター外のサービスを使用する場合は、これらをサービスブローカーで使用できますが、Operator もこれらのクラスター外のサービスに使用できます。

1.2. Operator Framework

Operator Framework は、上記のカスタマーエクスペリエンスに関連して提供されるツールおよび機能のファミリーです。これは、コードを作成するためだけにあるのではなく、Operator のテスト、実行、および更新などの重要な機能を実行します。Operator Framework コンポーネントは、これらの課題に対応するためのオープンソースツールで構成されています。

- Operator SDK

- Operator SDK は Kubernetes API の複雑性を把握していなくても、それぞれの専門知識に基づいて独自の Operator のブートストラップ、ビルド、テストおよびパッケージ化を実行できるよう Operator の作成者を支援します。

- Operator Lifecycle Manager

- Operator Lifecycle Manager は、クラスター内の Operator のインストール、アップグレード、ロールベースのアクセス制御 (RBAC) を制御します。OpenShift Container Platform 4.3 ではデフォルトでデプロイされます。

- Operator レジストリー

- Operator レジストリーは、クラスターで作成するための ClusterServiceVersion (CSV) およびカスタムリソース定義 (CRD) を保存し、パッケージおよびチャネルについての Operator メタデータを保存します。これは Kubernetes または OpenShift クラスターで実行され、この Operator カタログデータを OLM に指定します。

- OperatorHub

- OperatorHub は、クラスター管理者がクラスター上にインストールする Operator を検出し、選択するための Web コンソールです。OpenShift Container Platform ではデフォルトでデプロイされます。

- Operator Metering

- Operator Metering は、クラスター上で Day 2 管理についての Operator の運用上のメトリクスを収集し、使用状況のメトリクスを集計します。

これらのツールは組み立て可能なツールとして設計されているため、役に立つと思われるツールを使用できます。

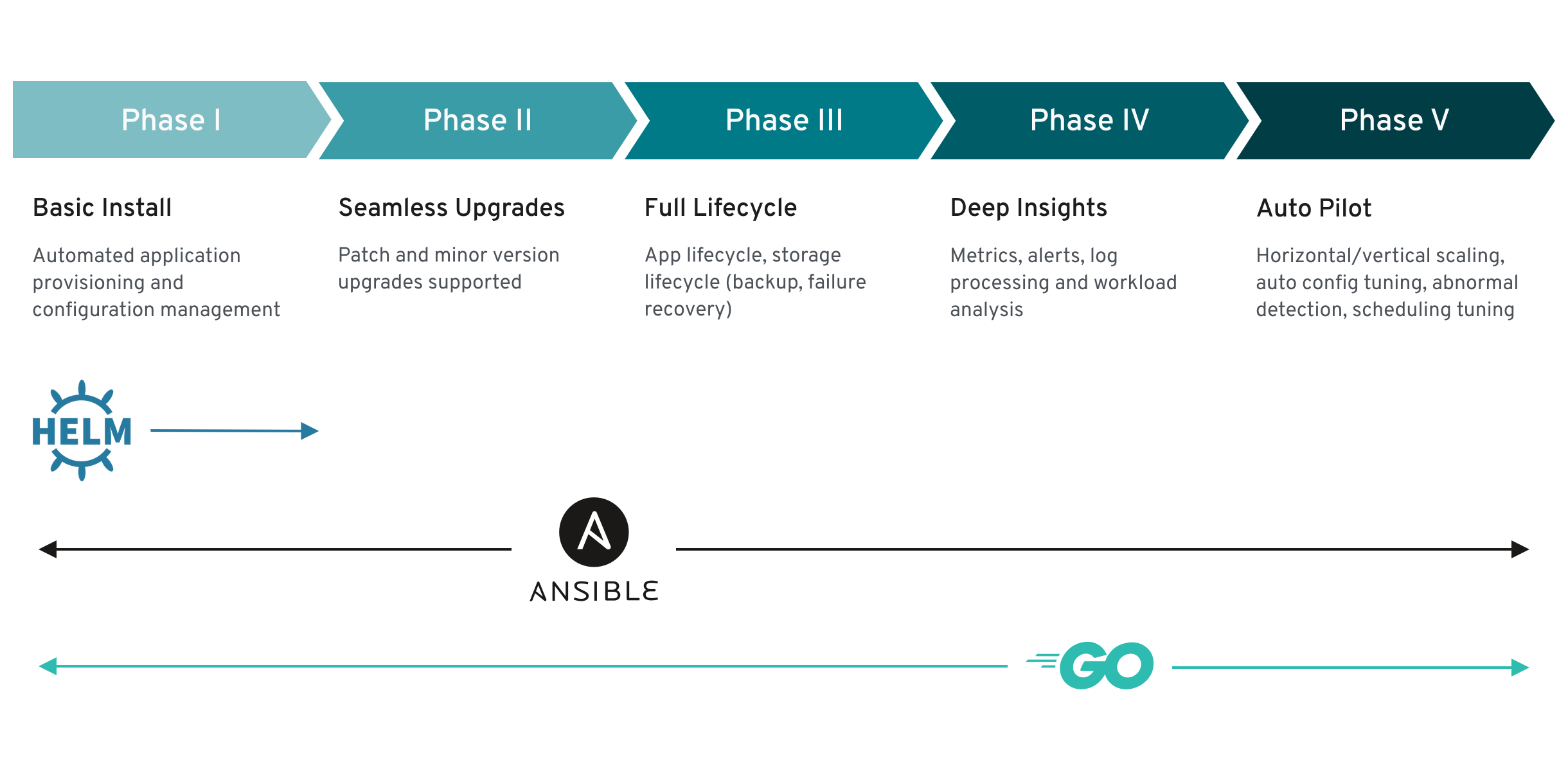

1.3. Operator 成熟度モデル

Operator 内にカプセル化されている管理ロジックの複雑さのレベルはさまざまです。また、このロジックは通常 Operator によって表されるサービスのタイプによって大きく変わります。

ただし、大半の Operator に含まれる特定の機能セットについては、Operator のカプセル化された操作の成熟度を一般化することができます。このため、以下の Operator 成熟度モデルは、 Operator の一般的な Day 2 オペレーションについての 5 つのフェーズの成熟度を定義しています。

図1.1 Operator 成熟度モデル

上記のモデルでは、これらの機能を Operator SDK の Helm、Go、および Ansible 機能で最適に開発する方法も示します。

第2章 Operator Lifecycle Manager (OLM) について

2.1. Operator Lifecycle Manager のワークフローおよびアーキテクチャー

以下では、OpenShift Container Platform における Operator Lifecycle Manager (OLM) の概念およびアーキテクチャーの概要を説明します。

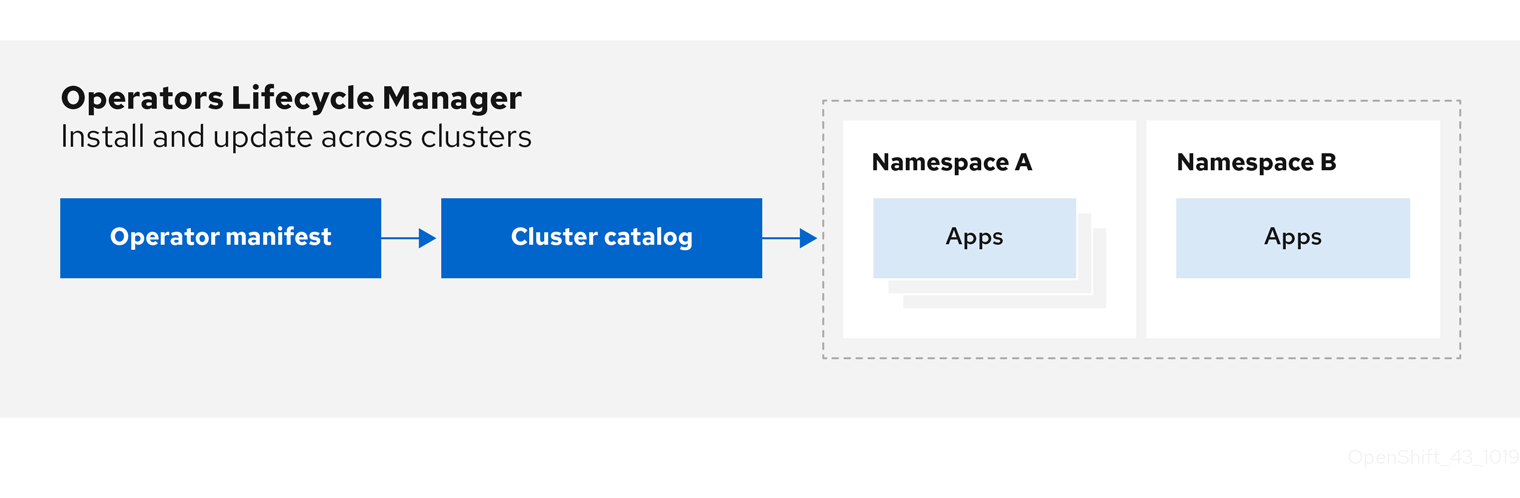

2.1.1. Operator Lifecycle Manager の概要

OpenShift Container Platform 4.3 では、 Operator Lifecycle Manager (OLM) を使用することにより、ユーザーはすべての Operator およびクラスター全体で実行される関連サービスをインストールし、更新し、管理することができます。これは、Kubernetes のネイティブアプリケーション (Operator) を効果的かつ自動化された拡張可能な方法で管理するために設計されたオープンソースツールキットの Operator Framework の一部です。

図2.1 Operator Lifecycle Manager ワークフロー

OLM は OpenShift Container Platform 4.3 でデフォルトで実行されます。これは、クラスター管理者がクラスターで実行されている Operator をインストールし、アップグレードし、アクセスをこれに付与するのに役立ちます。OpenShift Container Platform Web コンソールは、クラスター管理者が Operator をインストールしたり、クラスターで利用可能な Operator のカタログを使用できるように特定のプロジェクトアクセスを付与したりするのに使用する管理画面を提供します。

開発者の場合には、セルフサービスを使用することで、専門的な知識がなくてもデータベースのインスタンスのプロビジョニングや設定、またモニタリング、ビッグデータサービスなどを実行できます。 Operator にそれらに関するナレッジが織り込まれているためです。

2.1.2. ClusterServiceVersion (CSV)

ClusterServiceVersion (CSV) は、Operator Lifecycle Manager (OLM) のクラスターでの Operator の実行を支援する Operator メタデータから作成される YAML マニフェストです。

CSV は、ユーザーインターフェースにロゴ、説明、およびバージョンなどの情報を設定するために使用される Operator コンテナーイメージを伴うメタデータです。また、これは Operator が必要とする RBAC ルールやそれが管理したり、依存したりするカスタムリース(Custom Resource、CR) などの、Operator を実行するために必要な技術情報の情報源にもなります。

CSV は以下で構成されます。

- メタデータ

アプリケーションメタデータ:

- 名前、説明、バージョン (semver 準拠)、リンク、ラベル、アイコンなど

- インストールストラテジー

タイプ: Deployment

- サービスアカウントおよび必要なパーミッションのセット

- Deployment のセット。

- CRD

- タイプ

- Owned: サービスで管理されます。

- Required: サービスが実行されるためにクラスターに存在する必要があります。

- Resources: Operator が対話するリソースの一覧です。

- Descriptors: 意味情報を提供するために CRD 仕様およびステータスフィールドにアノテーションを付けます。

2.1.3. OLM での Operator のインストールおよびアップグレードのワークフロー

Operator Lifecycle Manager (OLM) エコシステムでは、以下のリソースを使用して Operator インストールおよびアップグレードを解決します。

- ClusterServiceVersion (CSV)

- CatalogSource

- Subscription

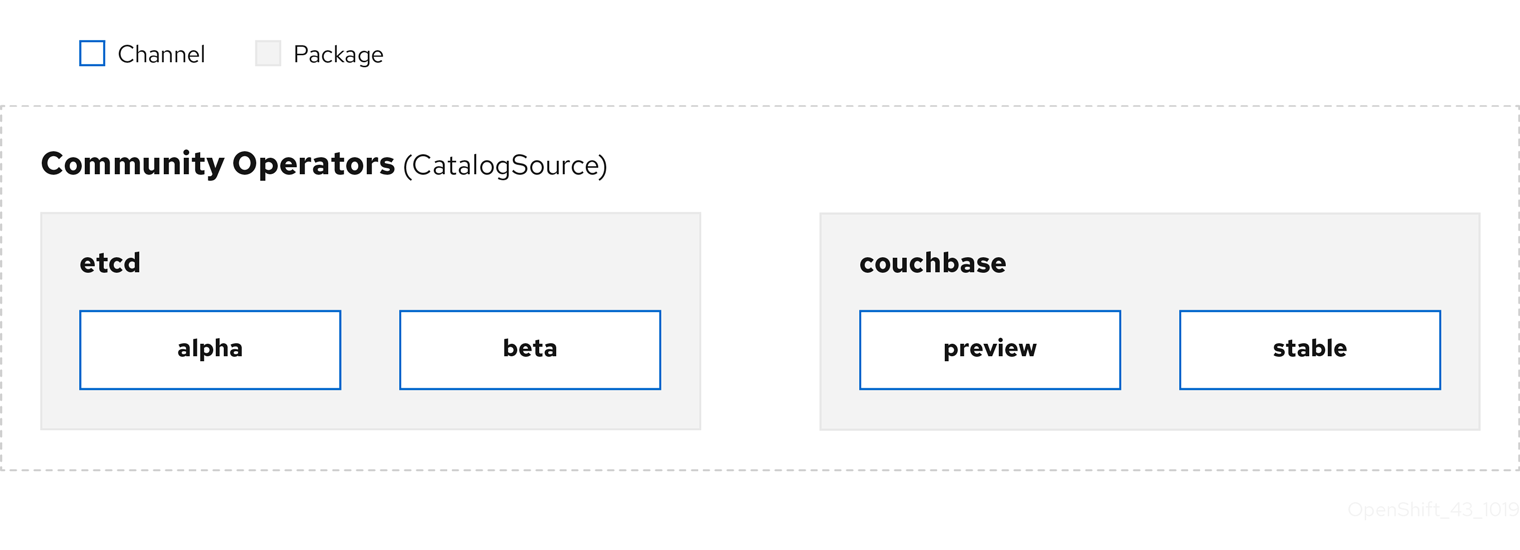

CSV で定義される Operator メタデータは CatalogSource というコレクションに保存できます。OLM は CatalogSource を使用します。これは Operator Registry API を使用して利用可能な Operator やインストールされた Operator のアップグレードについてクエリーします。

図2.2 CatalogSource の概要

CatalogSource 内で、Operator は パッケージ と チャネル という更新のストリームに編成されます。これは、Web ブラウザーのような継続的なリリースサイクルの OpenShift Container Platform や他のソフトウェアで使用される更新パターンです。

図2.3 CatalogSource のパッケージおよびチャネル

ユーザーは Subscription の特定の CatalogSource の特定のパッケージおよびチャネルを指定できます (例: etcd パッケージおよびその alpha チャネル)。Subscription が namespace にインストールされていないパッケージに対して作成されると、そのパッケージの最新 Operator がインストールされます。

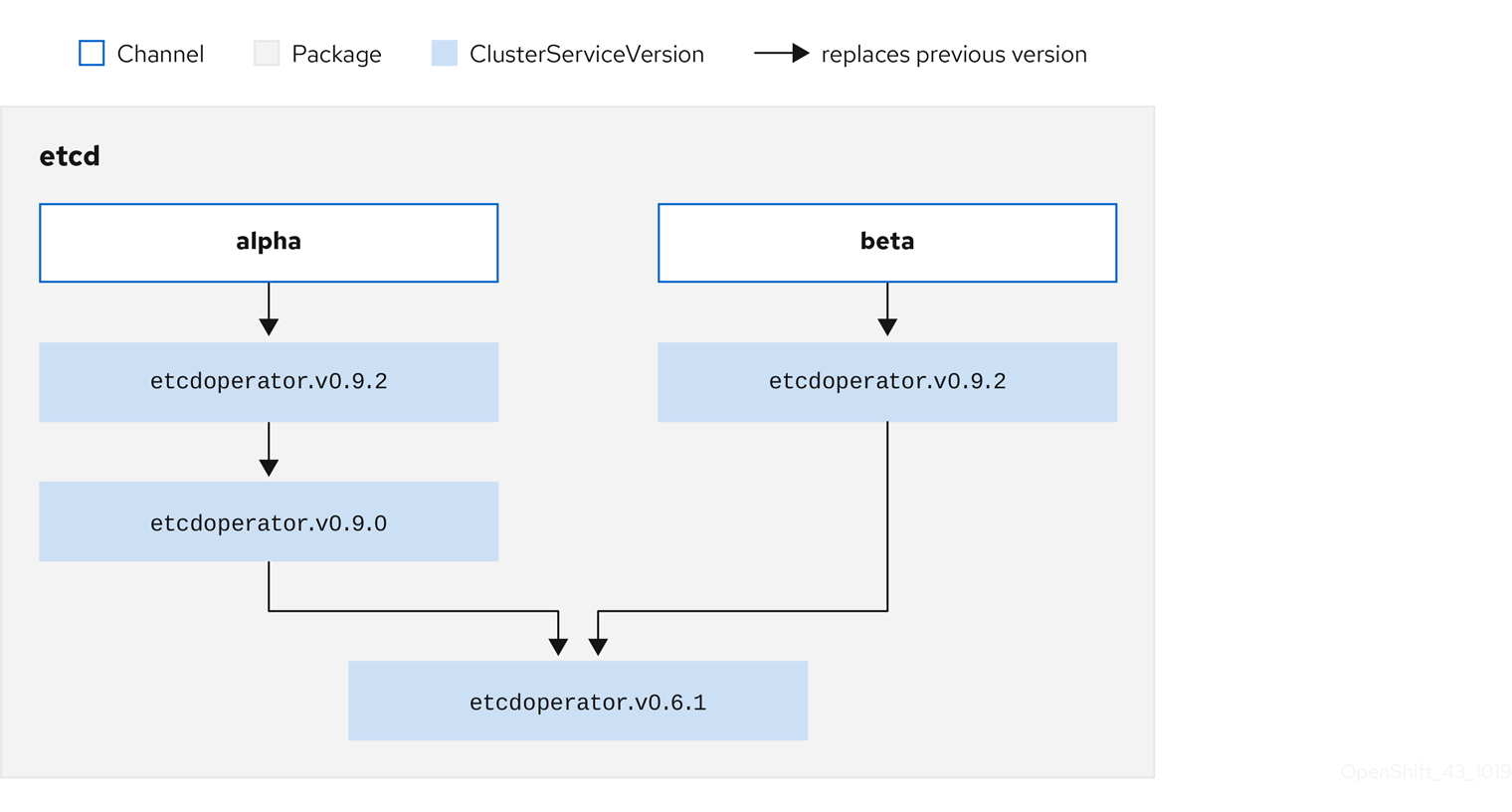

OLM では、バージョンの比較が意図的に避けられます。そのため、所定の catalog → channel → package パスから利用可能な「latest」または「newest」 Operator が必ずしも最も高いバージョン番号である必要はありません。これは Git リポジトリーの場合と同様に、チャネルの Head リファレンスとして見なされます。

各 CSV には、これが置き換える Operator を示唆する replaces パラメーターがあります。これにより、OLM でクエリー可能な CSV のグラフが作成され、更新がチャネル間で共有されます。チャネルは、更新グラフのエントリーポイントと見なすことができます。

図2.4 利用可能なチャネル更新についての OLM グラフ

例:

パッケージのチャネル

packageName: example

channels:

- name: alpha

currentCSV: example.v0.1.2

- name: beta

currentCSV: example.v0.1.3

defaultChannel: alpha

CatalogSource、パッケージ、チャネルおよび CSV がある状態で、OLM が更新のクエリーを実行できるようにするには、カタログが入力された CSV の置き換え (replaces) を実行する単一 CSV を明確にかつ確定的に返すことができる必要があります。

2.1.3.1. アップグレードパスの例

アップグレードシナリオのサンプルについて、CSV バージョン 0.1.1 に対応するインストールされた Operator について見てみましょう。OLM は CatalogSource をクエリーし、新規 CSV バージョン 0.1.3 についてのサブスクライブされたチャネルのアップグレードを検出します。これは、古いバージョンでインストールされていない CSV バージョン 0.1.2 を置き換えます。その後、さらに古いインストールされた CSV バージョン 0.1.1 を置き換えます。

OLM は、チャネルヘッドから CSV で指定された replaces フィールドで以前のバージョンに戻り、アップグレードパス 0.1.3 → 0.1.2 → 0.1.1 を判別します。矢印の方向は前者が後者を置き換えることを示します。OLM は、チャネルヘッドに到達するまで Operator を 1 バージョンずつアップグレードします。

このシナリオでは、OLM は Operator バージョン 0.1.2 をインストールし、既存の Operator バージョン 0.1.1を置き換えます。その後、Operator バージョン 0.1.3 をインストールし、直前にインストールされた Operator バージョン 0.1.2 を置き換えます。この時点で、インストールされた Operator のバージョン 0.1.3 はチャネルヘッドに一致し、アップグレードは完了します。

2.1.3.2. アップグレードの省略

OLM のアップグレードの基本パスは以下のとおりです。

- CatalogSource は Operator への 1 つ以上の更新に応じて更新されます。

- OLM は、CatalogSource に含まれる最新バージョンに到達するまで、Operator のすべてのバージョンを横断します。

ただし、この操作の実行は安全でない場合があります。公開されているバージョンの Operator がクラスターにインストールされていない場合、そのバージョンによって深刻な脆弱性が導入される可能性があるなどの理由でその Operator をがクラスターにインストールできないことがあります。

この場合、OLM は以下の 2 つのクラスターの状態を考慮に入れて、それらの両方に対応する更新グラフを提供する必要があります。

- 「問題のある」中間 Operator がクラスターによって確認され、かつインストールされている。

- 「問題のある」中間 Operator がクラスターにまだインストールされていない。

OLM は、新規カタログを送り、省略されたリリースを追加することで、クラスターの状態や問題のある更新が発見されたかどうかにかかわらず、単一の固有の更新を常に取得することができます。

例:

省略されたリリースの CSV

apiVersion: operators.coreos.com/v1alpha1

kind: ClusterServiceVersion

metadata:

name: etcdoperator.v0.9.2

namespace: placeholder

annotations:

spec:

displayName: etcd

description: Etcd Operator

replaces: etcdoperator.v0.9.0

skips:

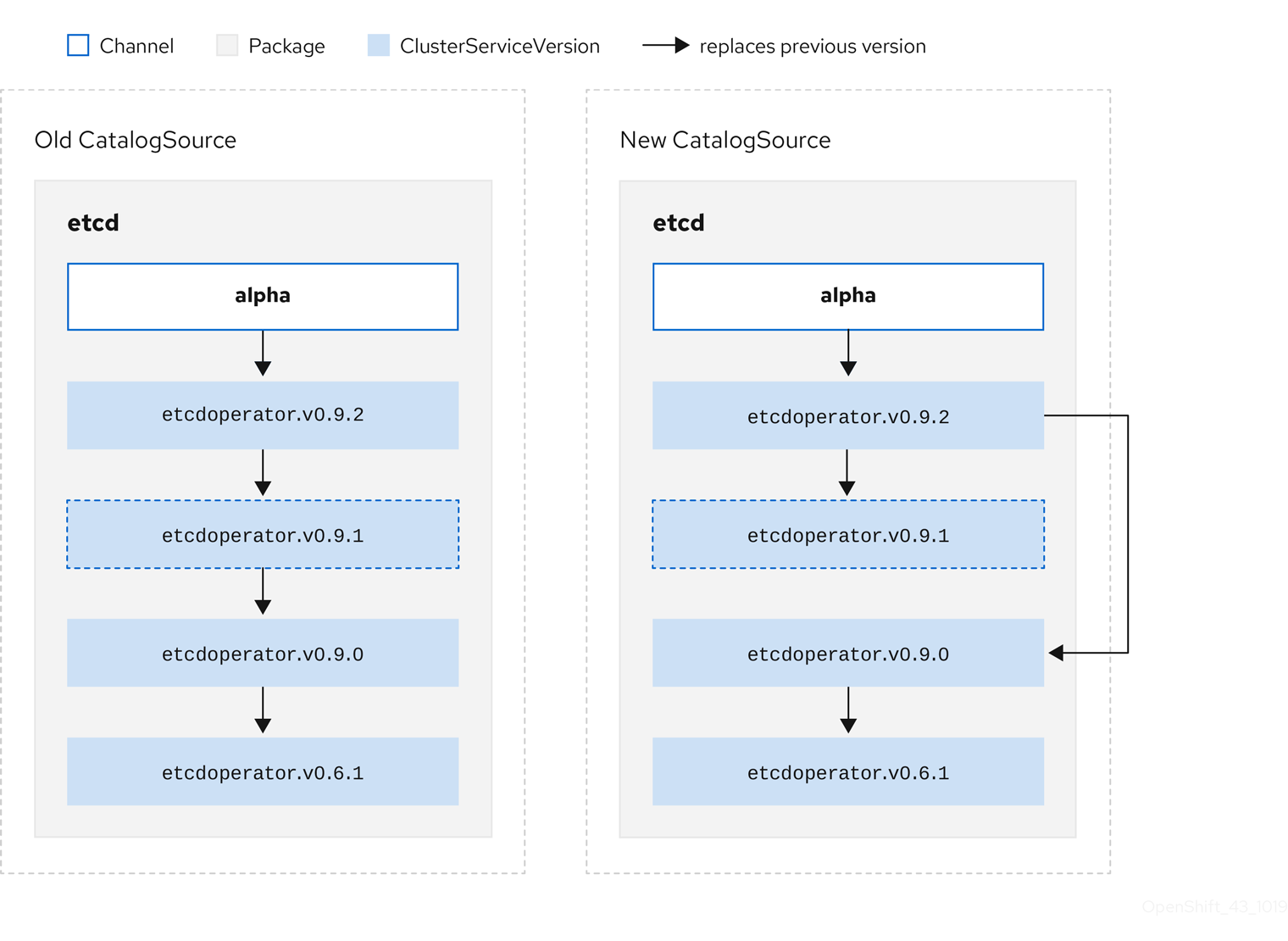

- etcdoperator.v0.9.1古い CatalogSource と 新規 CatalogSource についての以下の例を見てみましょう。

図2.5 更新のスキップ

このグラフは、以下を示しています。

- 古い CatalogSource の Operator には、新規 CatalogSource の単一の置き換えがある。

- 新規 CatalogSource の Operator には、新規 CatalogSource の単一の置き換えがある。

- 問題のある更新がインストールされていない場合、これがインストールされることはない。

2.1.3.3. 複数 Operator の置き換え

説明されているように新規 CatalogSource を作成する場合、1 つの Operator を置き換える (replace) が、複数バージョンを省略 (skip) できる CSV を公開する必要があります。これは、skipRange アノテーションを使用して実行できます。

olm.skipRange: <semver_range>

ここで <semver_range> には、semver ライブラリーでサポートされるバージョン範囲の形式が使用されます。

カタログで更新を検索する場合、チャネルのヘッドに skipRange アノテーションがあり、現在インストールされている Operator にその範囲内のバージョンフィールドがある場合、OLM はチャネル内の最新エントリーに対して更新されます。

以下は動作が実行される順序になります。

-

Subscription の

sourceNameで指定されるソースのチャネルヘッド (省略する他の条件が満たされている場合)。 -

sourceNameで指定されるソースの現行バージョンを置き換える次の Operator。 - Subscription に表示される別のソースのチャネルヘッド (省略する他の条件が満たされている場合)。

- Subscription に表示されるソースの現行バージョンを置き換える次の Operator。

例:

skipRange のある CSV

apiVersion: operators.coreos.com/v1alpha1

kind: ClusterServiceVersion

metadata:

name: elasticsearch-operator.v4.1.2

namespace: <namespace>

annotations:

olm.skipRange: '>=4.1.0 <4.1.2'2.1.3.4. z-stream サポート

z-streamまたはパッチリリースは、同じマイナーバージョンの以前のすべての z-stream リリースを置き換える必要があります。OLM は、メジャー、マイナーまたはパッチバージョンを区別せず、カタログ内で正確なグラフを作成する必要があります。

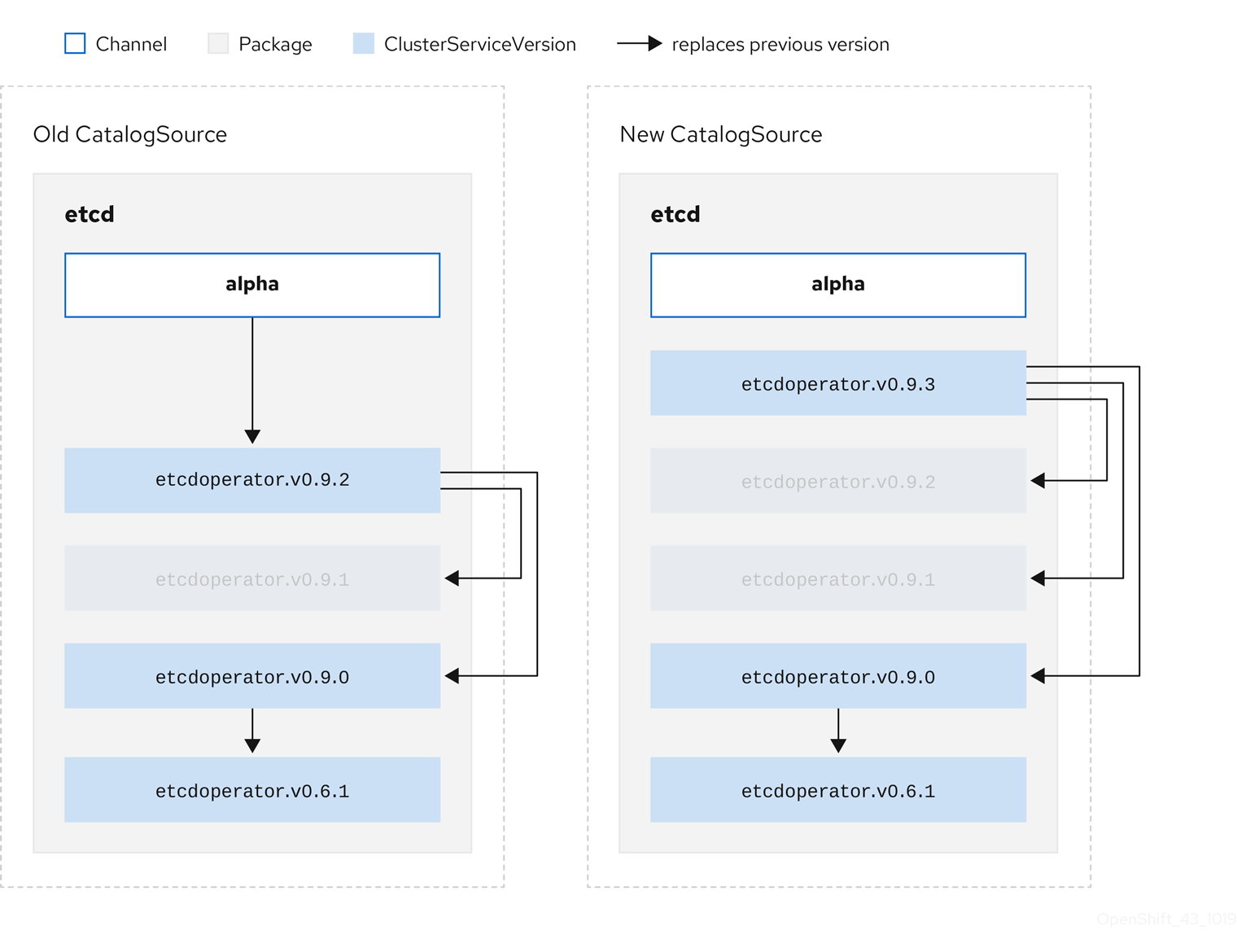

つまり、OLM では古い CatalogSource のグラフを使用し、上記のように新規 CatalogSource のグラフを生成する必要があります。

図2.6 複数 Operator の置き換え

このグラフは、以下を示しています。

- 古い CatalogSource の Operator には、新規 CatalogSource の単一の置き換えがある。

- 新規 CatalogSource の Operator には、新規 CatalogSource の単一の置き換えがある。

- 古い CatalogSource の z-stream リリースは、新規 CatalogSource の最新 z-stream リリースに更新される。

- 使用不可のリリースは「仮想」グラフノードと見なされる。それらのコンテンツは存在する必要がなく、レジストリーはグラフが示すように応答することのみが必要になります。

2.1.4. Operator Lifecycle Manager アーキテクチャー

Operator Lifecycle Manager は、OLM Operator および Catalog Operator の 2 つの Operator で構成されています。

これらの Operator はそれぞれ OLM フレームワークのベースとなるカスタムリソース定義 (Custom Resource Definition、CRD) を管理します。

| リソース | 短縮名 | 所有する Operator | 説明 |

|---|---|---|---|

| ClusterServiceVersion |

| OLM | アプリケーションのメタデータ: 名前、バージョン、アイコン、必須リソース、インストールなど。 |

| InstallPlan |

| カタログ | CSV を自動的にインストールするか、またはアップグレードするために作成されるリソースの計算された一覧。 |

| CatalogSource |

| カタログ | CSV、CRD、およびアプリケーションを定義するパッケージのリポジトリー。 |

| Subscription |

| カタログ | パッケージのチャネルを追跡して CSV を最新の状態に保つために使用されます。 |

| OperatorGroup |

| OLM | 複数の namespace をグループ化し、それらを Operator で使用できるように準備するために使用されます。 |

これらの Operator のそれぞれはリソースの作成も行います。

| リソース | 所有する Operator |

|---|---|

| Deployment | OLM |

| ServiceAccount | |

| (Cluster)Role | |

| (Cluster)RoleBinding | |

| Custom Resource Definition (CRD) | カタログ |

| ClusterServiceVersion (CSV) |

2.1.4.1. OLM Operator

OLM Operator は、CSV で指定された必須リソースがクラスター内にあることが確認された後に CSV リソースで定義されるアプリケーションをデプロイします。

OLM Operator は必須リソースの作成には関与せず、ユーザーが CLI を使用してこれらのリソースを手動で作成したり、カタログ Operator を使用してこれらのリソースを作成することを選択することができます。このタスクの分離により、アプリケーションに OLM フレームワークをどの程度活用するかに関連してユーザーによる追加機能の購入を可能にします。

OLM Operator はすべての namespace を監視するように設定されることが多い一方で、それらすべてが別々の namespace を管理する限り、他の OLM Operator と並行して操作することができます。

OLM Operator のワークフロー

namespace で ClusterServiceVersion (CSV) の有無を確認し、要件を満たしていることを確認します。その場合、CSV のインストールストラテジーを実行します。

注記CSV は、インストールストラテジーの実行を可能にするには、OperatorGroup のアクティブなメンバーである必要があります。

2.1.4.2. カタログ Operator

カタログ Operator は CSV およびそれらが指定する必須リソースを解決し、インストールします。また、 CatalogSource でチャネル内のパッケージへの更新の有無を確認し、それらを利用可能な最新バージョンに (オプションで自動的に) アップグレードします。

チャネル内のパッケージを追跡する必要のあるユーザーは、必要なパッケージ、チャネル、および更新のプルに使用する CatalogSource を設定する Subscription リソースを作成します。 更新が見つかると、ユーザーに代わって適切な InstallPlan の namespace への書き込みが行われます。

また、ユーザーは必要な CSV および承認ストラテジーの名前を含む InstallPlan リソースを直接作成でき、カタログ Operator はすべての必須リソースの作成の実行計画を作成します。これが承認されると、カタログ Operator はすべてのリソースを InstallPlan に作成します。 その後、これが単独で OLM Operator の要件を満たすと、CSV のインストールに移行します。

カタログ Operator のワークフロー

- 名前でインデックス化される CRD および CSV のキャッシュがあることを確認します。

ユーザーによって作成された未解決の InstallPlan の有無を確認します。

- 要求される名前に一致する CSV を検索し、これを解決済みリソースとして追加します。

- 管理対象または必須の CRD のそれぞれについて、これを解決済みリソースとして追加します。

- 必須 CRD のそれぞれについて、これを管理する CSV を検索します。

- 解決済みの InstallPlan の有無を確認し、それについての検出されたすべてのリソースを作成します (ユーザーによって、または自動的に承認される場合)。

- CatalogSource および Subscription の有無を確認し、それらに基づいて InstallPlan を作成します。

2.1.4.3. カタログレジストリー

カタログレジストリーは、クラスター内での作成用に CSV および CRD を保存し、パッケージおよびチャネルについてのメタデータを保存します。

パッケージマニフェスト は、パッケージアイデンティティーを CSV のセットに関連付けるカタログレジストリー内のエントリーです。パッケージ内で、チャネルは特定の CSV を参照します。CSV は置き換え対象の CSV を明示的に参照するため、パッケージマニフェストはカタログ Operator に対し、CSV をチャネル内の最新バージョンに更新するために必要なすべての情報を提供します (各中間バージョンをステップスルー)。

2.1.5. 公開されるメトリクス

Operator Lifecycle Manager (OLM) は、Prometheus ベースの OpenShift Container Platform クラスターモニタリングスタックで使用される特定の OLM 固有のリソースを公開します。

| 名前 | 説明 |

|---|---|

|

| CatalogSource の数。 |

|

|

ClusterServiceVersion (CSV) を調整する際に、(インストールされていない場合など)CSV バージョンが |

|

| 正常に登録された CSV の数。 |

|

|

CSV を調整する際に、CSV バージョンが |

|

| CSV アップグレードの単調 (monotonic) カウント。 |

|

| InstallPlan の数。 |

|

| Subscription の数。 |

|

|

Subscription 同期の単調 (monotonic) カウント。 |

2.2. Operator Lifecycle Manager の依存関係の解決

本書では、OpenShift Container Platform の Operator Lifecycle Manager (OLM) 内の依存関係の解決およびカスタムリソース定義 (CRD) アップグレードライフサイクルについて説明します。

2.2.1. 依存関係の解決

OLM は、実行中の Operator の依存関係の解決およびアップグレードライフサイクルを管理します。多くの場合、OLM が直面する問題は yum や rpm などの他のオペレーティングシステムパッケージマネージャーと同様です。

ただし、OLM には通常同様のシステムには 1 つの制約があります。それは、Opearator は常に実行中であるため、OLM は相互に機能しない Operator のセットの共存を防ごうとする点です。

つまり、これは OLM が以下を実行しないことを意味します。

- 提供できない API を必要とする Operator のセットのインストール

- Operator と依存関係のあるものに障害を発生させる仕方での Operator の更新

2.2.2. カスタムリソース定義 (Custom Resource Definition、CRD) のアップグレード

OLM は、単一の Cluster Service Version (CSV) によって所有されている場合にはカスタムリソース定義 (CRD) をすぐにアップグレードします。CRD が複数の CSV によって所有されている場合、CRD は、以下の後方互換性の条件のすべてを満たす場合にアップグレードされます。

- 現行 CRD の既存の有効にされたバージョンすべてが新規 CRD に存在する。

- 検証が新規 CRD の検証スキーマに対して行われる場合、CRD の有効にされたバージョンに関連付けられる既存インスタンスまたはカスタムリソース (CR) すべてが有効である。

2.2.2.1. 新規 CRD バージョンの追加

手順

CRD の新規バージョンを追加するには、以下を実行します。

versionsセクションに CRD リソースの新規エントリーを追加します。たとえば、現在の CRD に 1 つのバージョン

v1alpha1があり、新規バージョンv1beta1を追加し、これを新規のストレージバージョンとしてマークをする場合に、以下を実行します。versions: - name: v1alpha1 served: true storage: false - name: v1beta11 served: true storage: true- 1

v1beta1の新規エントリーを追加します。

CSV で新規バージョンが使用されることが意図される場合は、CSV の

ownedセクションの CRD の参照バージョンが更新されていることを確認します。customresourcedefinitions: owned: - name: cluster.example.com version: v1beta11 kind: cluster displayName: Cluster- 1

versionを更新します。

- 更新された CRD および CSV をバンドルにプッシュします。

2.2.2.2. CRD バージョンの非推奨または削除

OLM は、CRD の有効にされたバージョンがすぐに削除されることを許可しません。その代わりに、CRD の非推奨バージョンを CRD の served フィールドを false に設定して無効にする必要があります。その後に、無効にされたバージョンではないバージョンを後続の CRD アップグレードで削除できます。

手順

特定バージョンの CRD を非推奨にし、削除するには、以下を実行します。

非推奨バージョンを non-serving (無効にされたバージョン) とマークして、このバージョンが使用されなくなり、後続のアップグレードで削除される可能性があることを示します。例:

versions: - name: v1alpha1 served: false1 storage: true- 1

falseに設定します。

非推奨となるバージョンが現在

storageバージョンの場合、storageバージョンを有効にされたバージョンに切り替えます。例:versions: - name: v1alpha1 served: false storage: false1 - name: v1beta1 served: true storage: true2 注記CRD から

storageバージョンであるか、このバージョンであった特定のバージョンを削除するために、そのバージョンが CRD のステータスのstoredVersionから削除される必要があります。OLM は、保存されたバージョンが新しい CRD に存在しないことを検知した場合に、この実行を試行します。- 上記の変更内容で CRD をアップグレードします。

後続のアップグレードサイクルでは、無効にされたバージョンを CRD から完全に削除できます。例:

versions: - name: v1beta1 served: true storage: true-

該当バージョンが CRD から削除される場合、CSV の

ownedセクションにある CRD の参照バージョンも更新されていることを確認します。

2.2.3. 依存関係解決のシナリオ例

以下の例で、プロバイダー は CRD または APIService を「所有」する Operator です。

例: 依存 API を非推奨にする

A および B は API である (例: CRD):

- A のプロバイダーは B に依存する。

- B のプロバイダーには Subscription がある。

- B のプロバイダーは C を提供するように更新するが、B を非推奨にする。

この結果は以下のようになります。

- B にはプロバイダーがなくなる。

- A は機能しなくなる。

これは OLM がアップグレードストラテジーで回避するケースです。

例: バージョンのデッドロック

A および B は API である:

- A のプロバイダーには B が必要。

- B のプロバイダーには A が必要。

- A のプロバイダーは (A2 を提供し、B2 を必要とするように) 更新され、A を非推奨にする。

- B のプロバイダーは (B2 を提供し、A2 を必要とするように) 更新され、B を非推奨にする。

OLM が B を同時に更新せずに A を更新しようとする場合や、その逆の場合、OLM は、新しい互換性のあるセットが見つかったとしても Operator の新規バージョンに進むことができません。

これは OLM がアップグレードストラテジーで回避するもう 1 つのケースです。

2.3. OperatorGroup

以下では、OpenShift Container Platform における Operator Lifecycle Manager (OLM) の OperatorGroup の使用について説明します。

2.3.1. OperatorGroup

OperatorGroup は、マルチテナント設定を OLM でインストールされた Operator に提供する OLM リソースです。OperatorGroup は、そのメンバー Operator に必要な RBAC アクセスを生成するために使用するターゲット namespace を選択します。

ターゲット namespace のセットは、ClusterServiceVersion (CSV) の olm.targetNamespaces アノテーションに保存されるカンマ区切りの文字列によって指定されます。このアノテーションは、メンバー Operator の CSV インスタンスに適用され、それらのデプロインメントに展開されます。

2.3.2. OperatorGroup メンバーシップ

Operator は、以下の条件が true の場合に OperatorGroup の メンバー とみなされます。

- Operator の CSV が OperatorGroup と同じ namespace にある。

- Operator の CSV の InstallMode は OperatorGroup がターゲットに設定する namespace のセットをサポートする。

InstallMode は InstallModeType フィールドおよびブール値の Supported フィールドで構成される。CSV の仕様には、4 つの固有の InstallModeTypes の InstallMode のセットを含めることができます。

| InstallMode タイプ | 説明 |

|---|---|

|

| Operator は、独自の namespace を選択する OperatorGroup のメンバーにすることができます。 |

|

| Operator は 1 つの namespace を選択する OperatorGroup のメンバーにすることができます。 |

|

| Operator は複数の namespace を選択する OperatorGroup のメンバーにすることができます。 |

|

|

Operator はすべての namespace を選択する OperatorGroup のメンバーにすることができます (設定されるターゲット namespace は空の文字列 |

CSV の仕様が InstallModeType のエントリーを省略する場合、そのタイプは暗黙的にこれをサポートする既存エントリーによってサポートが示唆されない限り、サポートされないものとみなされます。

2.3.3. ターゲット namespace の選択

spec.targetNamespaces パラメーターを使用して OperatorGroup のターゲット namespace に名前を明示的に指定することができます。

apiVersion: operators.coreos.com/v1

kind: OperatorGroup

metadata:

name: my-group

namespace: my-namespace

spec:

targetNamespaces:

- my-namespace

または、spec.selector パラメーターでラベルセレクターを使用して namespace を指定することもできます。

apiVersion: operators.coreos.com/v1

kind: OperatorGroup

metadata:

name: my-group

namespace: my-namespace

spec:

selector:

cool.io/prod: "true"

spec.targetNamespaces で複数の namespace を一覧表示したり、spec.selector でラベルセレクターを使用したりすることは推奨されません。OperatorGroup の複数のターゲット namespace のサポートは今後のリリースで取り除かれる可能性があります。

spec.targetNamespaces と spec.selector の両方が定義されている場合、 spec.selector は無視されます。または、spec.selector と spec.targetNamespaces の両方を省略し、global OperatorGroup を指定できます。 これにより、すべての namespace が選択されます。

apiVersion: operators.coreos.com/v1

kind: OperatorGroup

metadata:

name: my-group

namespace: my-namespace

選択された namespace の解決済みのセットは OperatorGroup の status.namespaces フィールドに表示されます。グローバル OperatorGroup の status.namespace には空の文字列 ("") が含まれます。 これは、消費する Operator に対し、すべての namespace を監視するように示唆します。

2.3.4. OperatorGroup CSV アノテーション

OperatorGroup のメンバー CSV には以下のアノテーションがあります。

| アノテーション | 説明 |

|---|---|

|

| OperatorGroup の名前が含まれます。 |

|

| OperatorGroup の namespace が含まれます。 |

|

| OperatorGroup のターゲット namespace 選択を一覧表示するカンマ区切りの文字列が含まれます。 |

olm.targetNamespaces 以外のすべてのアノテーションがコピーされた CSV と共に含まれます。olm.targetNamespaces アノテーションをコピーされた CSV で省略すると、テナント間のターゲット namespace の重複が回避されます。

2.3.5. 提供される API アノテーション

OperatorGroup によって提供される GroupVersionKinds (GVK) についての情報が olm.providedAPIs アノテーションに表示されます。アノテーションの値は、カンマで区切られた <kind>.<version>.<group> で構成される文字列です。OperatorGroup のすべてのアクティブメンバーの CSV によって提供される CRD および APIService の GVK が含まれます。

PackageManifest リソースを提供する単一のアクティブメンバー CSV を含む OperatorGroup の以下の例を確認してください。

apiVersion: operators.coreos.com/v1

kind: OperatorGroup

metadata:

annotations:

olm.providedAPIs: PackageManifest.v1alpha1.packages.apps.redhat.com

name: olm-operators

namespace: local

...

spec:

selector: {}

serviceAccount:

metadata:

creationTimestamp: null

targetNamespaces:

- local

status:

lastUpdated: 2019-02-19T16:18:28Z

namespaces:

- local2.3.6. ロールベースのアクセス制御

OperatorGroup の作成時に、3 つの ClusterRole が生成されます。それぞれには、以下の示すように ClusterRoleSelector がラベルに一致するように設定された単一の AggregationRule が含まれます。

| ClusterRole | 一致するラベル |

|---|---|

|

|

|

|

|

|

|

|

|

以下の RBAC リソースは、CSV が AllNamespaces InstallMode のあるすべての namespace を監視しており、理由が InterOperatorGroupOwnerConflict の失敗状態にない限り、CSV が OperatorGroup のアクティブメンバーになる際に生成されます。

- CRD からの各 API リソースの ClusterRole

- APIService からの各 API リソースの ClusterRole

- 追加のロールおよびロールバインディング

| ClusterRole | 設定 |

|---|---|

|

|

集計ラベル:

|

|

|

集計ラベル:

|

|

|

集計ラベル:

|

|

|

Verbs on

集計ラベル:

|

| ClusterRole | 設定 |

|---|---|

|

|

集計ラベル:

|

|

|

集計ラベル:

|

|

|

集計ラベル:

|

追加のロールおよびロールバインディング

-

CSV が

*が含まれる 1 つのターゲット namespace を定義する場合、ClusterRole と対応する ClusterRoleBinding が CSV のパーミッションフィールドに定義されるパーミッションごとに生成されます。生成されたすべてのリソースにはolm.owner: <csv_name>およびolm.owner.namespace: <csv_namespace>ラベルが付与されます。 -

CSV が

*が含まれる 1 つのターゲット namespace を定義 しない 場合、olm.owner: <csv_name>およびolm.owner.namespace: <csv_namespace>ラベルの付いた Operator namespace にあるすべてのロールおよびロールバインディングがターゲット namespace にコピーされます。

2.3.7. コピーされる CSV

OLM は、それぞれの OperatorGroup のターゲット namespace の OperatorGroup のすべてのアクティブな CSV のコピーを作成します。コピーされる CSV の目的は、ユーザーに対して、特定の Operator が作成されるリソースを監視するように設定されたターゲット namespace について通知することにあります。コピーされる CSV にはステータスの理由 Copied があり、それらのソース CSV のステータスに一致するように更新されます。olm.targetNamespaces アノテーションは、クラスター上でコピーされる CSV が作成される前に取られます。ターゲット namespace 選択を省略すると、テナント間のターゲット namespace の重複が回避されます。コピーされる CSV はそれらのソース CSV が存在しなくなるか、またはそれらのソース CSV が属する OperatorGroup がコピーされた CSV の namespace をターゲットに設定しなくなると削除されます。

2.3.8. 静的 OperatorGroup

OperatorGroup はその spec.staticProvidedAPIs フィールドが true に設定されると 静的 になります。その結果、OLM は OperatorGroup の olm.providedAPIs アノテーションを変更しません。つまり、これを事前に設定することができます。これは、ユーザーが OperatorGroup を使用して namespace のセットでリソースの競合を防ぐ必要がある場合で、それらのリソースの API を提供するアクティブなメンバーの CSV がない場合に役立ちます。

以下は、something.cool.io/cluster-monitoring: "true" アノテーションのあるすべての namespace の Prometheus リソースを保護する OperatorGroup の例です。

apiVersion: operators.coreos.com/v1

kind: OperatorGroup

metadata:

name: cluster-monitoring

namespace: cluster-monitoring

annotations:

olm.providedAPIs: Alertmanager.v1.monitoring.coreos.com,Prometheus.v1.monitoring.coreos.com,PrometheusRule.v1.monitoring.coreos.com,ServiceMonitor.v1.monitoring.coreos.com

spec:

staticProvidedAPIs: true

selector:

matchLabels:

something.cool.io/cluster-monitoring: "true"2.3.9. OperatorGroup の交差部分

2 つの OperatorGroup は、それらのターゲット namespace セットの交差部分が空のセットではなく、olm.providedAPIs アノテーションで定義されるそれらの指定 API セットの交差部分が空のセットではない場合に、 交差部分のある指定 API があると見なされます。

これによって生じ得る問題として、交差部分のある指定 API を持つ複数の OperatorGroup は、一連の交差部分のある namespace で同じリソースに関して競合関係になる可能性があります。

交差ルールを確認すると、OperatorGroup の namespace は常に選択されたターゲット namespace の一部として組み込まれます。

交差のルール

アクティブメンバーの CSV が同期する際はいつでも、OLM はクラスターで、CSV の OperatorGroup とそれ以外のすべての間での交差部分のある指定 API のセットについてクエリーします。その後、OLM はそのセットが空のセットであるかどうかを確認します。

trueであり、CSV の指定 API が OperatorGroup のサブセットである場合:- 移行を継続します。

trueであり、CSV の指定 API が Operator Group のサブセット ではない 場合:OperatorGroup が静的である場合:

- CSV に属するすべてのデプロイメントをクリーンアップします。

-

ステータスの理由

CannotModifyStaticOperatorGroupProvidedAPIsのある失敗状態に CSV を移行します。

OperatorGroup が静的 ではない 場合:

-

OperatorGroup の

olm.providedAPIsアノテーションを、それ自体と CSV の指定 API の集合に置き換えます。

-

OperatorGroup の

falseであり、CSV の指定 API が OperatorGroupt のサブセット ではない 場合:- CSV に属するすべてのデプロイメントをクリーンアップします。

-

ステータスの理由

InterOperatorGroupOwnerConflictのある失敗状態に CSV を移行します。

falseであり、CSV の指定 API が OperatorGroup のサブセットである場合:OperatorGroup が静的である場合:

- CSV に属するすべてのデプロイメントをクリーンアップします。

-

ステータスの理由

CannotModifyStaticOperatorGroupProvidedAPIsのある失敗状態に CSV を移行します。

OperatorGroup が静的 ではない 場合:

-

OperatorGroup の

olm.providedAPIsアノテーションを、それ自体と CSV の指定 API 間の差異部分に置き換えます。

-

OperatorGroup の

OperatorGroup によって生じる失敗状態は非終了状態です。

以下のアクションは、OperatorGroup が同期するたびに実行されます。

- アクティブメンバーの CSV の指定 API のセットは、クラスターから計算されます。コピーされた CSV は無視されることに注意してください。

-

クラスターセットは

olm.providedAPIsと比較され、olm.providedAPIsに追加の API が含まれる場合は、それらの API がプルーニングされます。 - すべての namespace で同じ API を提供するすべての CSV は再びキューに入れられます。これにより、交差部分のあるグループ間の競合する CSV に対して、それらの競合が競合する CSV のサイズ変更または削除のいずれかによって解決されている可能性があることが通知されます。

2.3.10. OperatorGroup のトラブルシューティング

メンバーシップ

-

複数の OperatorGroup が単一の namespace にある場合、その namespace で作成されるすべての CSV は

TooManyOperatorGroupsの理由で失敗状態に切り替わります。この理由で失敗状態になる CSV は、それらの namespace の OperatorGroup 数が 1 になると保留状態に切り替わります。 -

CSV の InstallMode がその namespace で OperatorGroup のターゲット namespace 選択をサポートしない場合、CSV は

UnsupportedOperatorGroupの理由で失敗状態に切り替わります。この理由で失敗した状態にある CSV は、 OperatorGroup のターゲット namespace の選択がサポートされる設定に変更されるか、または CSV の InstallMode が OperatorGroup の target namespace 選択をサポートするように変更される場合に保留状態に切り替わります。

第3章 OperatorHub について

以下では、OperatorHub のアーキテクチャーについて説明します。

3.1. OperatorHub の概要

OperatorHub は OpenShift Container Platform Web コンソールで利用でき、クラスター管理者が Operator を検出し、インストールするために使用するインターフェースです。1 回のクリックで、Operator はクラスター外のソースからプルでき、クラスター上でインストールされ、サブスクライブされ、エンジニアリングチームが Operator Lifecycle Manager (OLM) を使用してデプロイメント環境で製品をセルフサービスで管理される状態にすることができます。

クラスター管理者は、以下のカテゴリーにグループ化された OperatorSource から選択することができます。

| カテゴリー | 説明 |

|---|---|

| Red Hat Operator | Red Hat によってパッケージ化され、出荷される Red Hat 製品。Red Hat によってサポートされます。 |

| 認定 Operator | 大手独立系ソフトウェアベンダー (ISV) の製品。Red Hat は ISV とのパートナーシップにより、パッケージ化および出荷を行います。ISV によってサポートされます。 |

| コミュニティー Operator | operator-framework/community-operators GitHub リポジトリーで関連するエンティティーによってメンテナンスされる、オプションで表示可能になるソフトウェア。正式なサポートはありません。 |

| カスタム Operator | 各自でクラスターに追加する Operator。カスタム Operator を追加しない場合、カスタムカテゴリーは Web コンソールの OperatorHub 上に表示されません。 |

OperatorHub コンテンツは 60 分ごとに自動的に更新されます。

OperatorHub の Operator は OLM で実行されるようにパッケージ化されます。これには、Operator のインストールおよびセキュアな実行に必要なすべての CRD、RBAC ルール、デプロイメント、およびコンテナーイメージが含まれる ClusterServiceVersion (CSV) という YAML ファイルが含まれます。また、機能の詳細やサポートされる Kubernetes バージョンなどのユーザーに表示される情報も含まれます。

Operator SDK は、開発者が OLM および OperatorHub で使用するために Operator のパッケージ化することを支援するために使用できます。お客様によるアクセスが可能な商用アプリケーションがある場合、Red Hat の ISV パートナーポータル (connect.redhat.com) で提供される認定ワークフローを使用してこれを組み込むようにしてください。

3.2. OperatorHub アーキテクチャー

OperatorHub UI コンポーネントは、デフォルトで OpenShift Container Platform の openshift-marketplace namespace で Marketplace Operator によって実行されます。

Marketplace Operator は OperatorHub および OperatorSource カスタムリソース定義 (CRD) を管理します。

一部の OperatorSource 情報は OperatorHub ユーザーインターフェースで公開されますが、それは独自の Operator を作成するユーザーによってのみ直接使用されます。

OperatorHub は CatalogSourceConfig リソースを使用しなくなりましたが、それらは OpenShift Container Platform で引き続きサポートされます。

3.2.1. OperatorHub CRD

OperatorHub CRD を使用して、クラスター上で OperatorHub で提供されているデフォルト OperatorSource の状態を enabled と disabled 間で切り替えることができます。この機能は、OpenShift Container Platform をネットワークが制限された環境で設定する際に役立ちます。

OperatorHub カスタムリソースの例

apiVersion: config.openshift.io/v1

kind: OperatorHub

metadata:

name: cluster

spec:

disableAllDefaultSources: true

sources: [

{

name: "community-operators",

disabled: false

}

]3.2.2. OperatorSource CRD

それぞれの Operator について、OperatorSource CRD は Operator バンドルを保存するために使用される外部データストアを定義するために使用されます。

OperatorSource カスタムリソースの例

apiVersion: operators.coreos.com/v1

kind: OperatorSource

metadata:

name: community-operators

namespace: marketplace

spec:

type: appregistry

endpoint: https://quay.io/cnr

registryNamespace: community-operators

displayName: "Community Operators"

publisher: "Red Hat" - 1

- データストアをアプリケーションレジストリーとして識別するために、

typeはappregistryに設定されます。 - 2

- 現時点で、Quay は OperatorHub によって使用される外部データストアであるため、エンドポイントは Quay.io

appregistryについてhttps://quay.io/cnrに設定されます。 - 3

- コミュニティー Operator の場合、

registryNamespaceはcommunity-operatorに設定されます。 - 4

- オプションで、

displayNameを、 OperatorHub UI の Operator の表示される名前に設定します。 - 5

- オプションで、

publisherを、OperatorHub UI に表示される Operator を公開する人または組織に設定します。

第4章 Operator のクラスターへの追加

以下では、クラスター管理者を対象に、Operator の OpenShift Container Platform クラスターへのインストールおよび Operator を namespace にサブスクライブする方法について説明します。

4.1. OperatorHub からの Operator のインストール

クラスター管理者は、OpenShift Container Platform Web コンソールまたは CLI を使用して OperatorHub から Operator をインストールできます。その後、Operator を 1 つまたは複数の namespace にサブスクライブし、クラスター上で開発者が使用できるようにできます。

インストール時に、Operator の以下の初期設定を判別する必要があります。

- インストールモード

- All namespaces on the cluster (default) を選択して Operator をすべての namespace にインストールするか、または (利用可能な場合は) 個別の namespace を選択し、選択された namespace のみに Operator をインストールします。この例では、All namespaces… を選択し、Operator をすべてのユーザーおよびプロジェクトで利用可能にします。

- 更新チャネル

- Operator が複数のチャネルで利用可能な場合、サブスクライブするチャネルを選択できます。たとえば、(利用可能な場合に) stable チャネルからデプロイするには、これを一覧から選択します。

- 承認ストラテジー

- 自動 (Automatic) または手動 (Manual) のいずれかの更新を選択します。インストールされた Operator について自動更新を選択する場合、Operator の新規バージョンが利用可能になると、Operator Lifecycle Manager (OLM) は人の介入なしに、Operator の実行中のインスタンスを自動的にアップグレードします。手動更新を選択する場合、Operator の新規バージョンが利用可能になると、OLM は更新要求を作成します。クラスター管理者は、Operator が新規バージョンに更新されるように更新要求を手動で承認する必要があります。

4.1.1. Web コンソールを使用した OperatorHub からのインストール

この手順では、Couchbase Operator をサンプルとして使用し、OpenShift Container Platform Web コンソールを使用して、OperatorHub から Operator をインストールし、これにサブスクライブします。

前提条件

-

cluster-adminパーミッションを持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできること。

手順

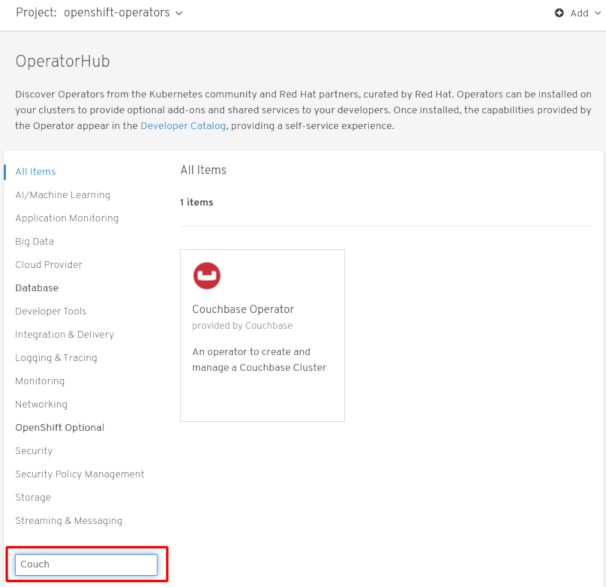

- Web コンソールで、Operators → OperatorHub ページに移動します。

スクロールするか、またはキーワードを Filter by keyword ボックスに入力し (この場合は

Couchbase)、必要な Operator を見つけます。図4.1 キーワードによる Operator のフィルター

- Operator を選択します。コミュニティー Operator の場合、Red Hat がそれらの Operator を認定していないことについての警告が出されます。作業を継続する前に、この警告を確認してください。Operator についての情報が表示されます。

- Operator についての情報を確認してから、Install をクリックします。

Create Operator Subscription ページで以下を実行します。

以下のいずれかを選択します。

-

All namespaces on the cluster (default) は、デフォルトの

openshift-operatorsnamespace で Operator をインストールし、クラスターのすべての namespace を監視し、Operator をこれらの namespace に対して利用可能にします。このオプションは常に選択可能です。 - A specific namespace on the cluster では、Operator をインストールする特定の単一 namespace を選択できます。Operator は監視のみを実行し、この単一 namespace で使用されるように利用可能になります。

-

All namespaces on the cluster (default) は、デフォルトの

- Update Channel を選択します (複数を選択できる場合)。

- 前述のように、自動 (Automatic) または 手動 (Manual) の承認ストラテジーを選択します。

Subscribe をクリックし、Operator をこの OpenShift Container Platform クラスターの選択した namespace で利用可能にします。

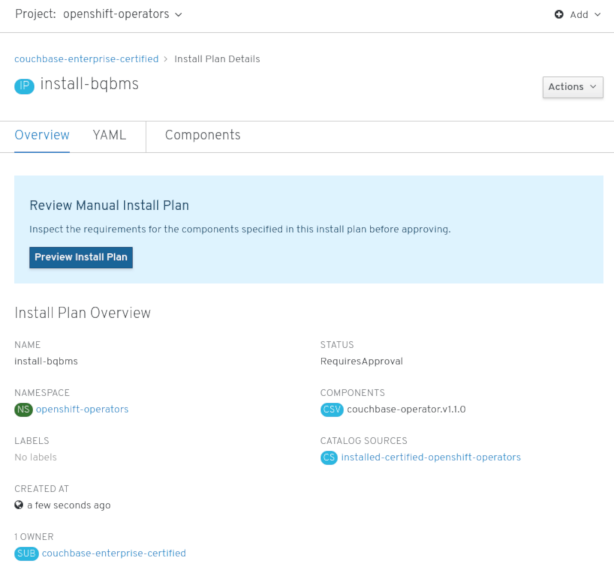

手動の承認ストラテジーを選択している場合、Subscription のアップグレードステータスは、その Install Plan を確認し、承認するまで Upgrading のままになります。

図4.2 Install Plan ページからの手動による承認

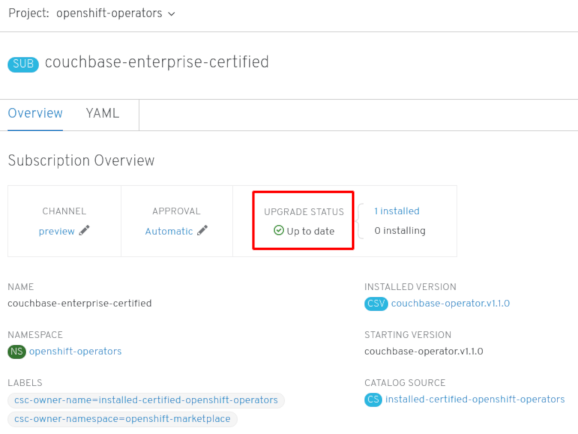

Install Plan ページでの承認後に、Subscription のアップグレードステータスは Up to date に移行します。

自動承認ストラテジーを選択している場合、アップグレードステータスは、介入なしに Up to date に解決するはずです。

図4.3 Subscription のアップグレードステータス「 Up to date」

Subscription のアップグレードステータスが Up to date になった後に、Operators → Installed Operators を選択して、 Couchbase ClusterServiceVersion (CSV) が表示され、その ステータス が最終的に関連する namespace で InstallSucceeded に解決することを確認します。

注記All namespaces… インストールモードの場合、ステータスは

openshift-operatorsnamespace で InstallSucceeded になりますが、他の namespace でチェックする場合、ステータスは Copied になります。上記通りにならない場合:

-

さらにトラブルシューティングを行うために問題を報告している Workloads → Pods ページで、

openshift-operatorsプロジェクト(または A specific namespace… インストールモードが選択されている場合は他の関連の namespace)の Pod のログを確認します。

-

さらにトラブルシューティングを行うために問題を報告している Workloads → Pods ページで、

4.1.2. CLI を使用した OperatorHub からのインストール

OpenShift Container Platform Web コンソールを使用する代わりに、CLI を使用して OperatorHub から Operator をインストールできます。oc コマンドを使用して、Subscription オブジェクトを作成または更新します。

前提条件

-

cluster-adminパーミッションを持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできること。 - oc コマンドをローカルシステムにインストールする。

手順

OperatorHub からクラスターで利用できる Operator の一覧を表示します。

$ oc get packagemanifests -n openshift-marketplace NAME CATALOG AGE 3scale-operator Red Hat Operators 91m amq-online Red Hat Operators 91m amq-streams Red Hat Operators 91m ... couchbase-enterprise-certified Certified Operators 91m mariadb Certified Operators 91m mongodb-enterprise Certified Operators 91m ... etcd Community Operators 91m jaeger Community Operators 91m kubefed Community Operators 91m ...必要な Operator の CatalogSource をメモします。

必要な Operator を検査して、サポートされる InstallMode および利用可能なチャネルを確認します。

$ oc describe packagemanifests <operator_name> -n openshift-marketplaceOperatorGroup は、OperatorGroup と同じ namespace 内のすべての Operator に必要な RBAC アクセスを生成するターゲット namespace を選択する OLM リソースです。

Operator をサブスクライブする namespace には、Operator の InstallMode に一致する OperatorGroup が必要になります (

AllNamespacesまたはSingleNamespaceモードのいずれか)。インストールする Operator がAllNamespacesを使用する場合、openshift-operatorsnamespace には適切な OperatorGroup がすでに配置されます。ただし、Operator が

SingleNamespaceモードを使用し、適切な OperatorGroup がない場合、それらを作成する必要があります。注記この手順の Web コンソールバージョンでは、

SingleNamespaceモードを選択する際に、OperatorGroup および Subscription オブジェクトの作成を背後で自動的に処理します。OperatorGroup オブジェクト YAML ファイルを作成します(例:

operatorgroup.yaml)。OperatorGroup の例

apiVersion: operators.coreos.com/v1 kind: OperatorGroup metadata: name: <operatorgroup_name> namespace: <namespace> spec: targetNamespaces: - <namespace>OperatorGroup オブジェクトを作成します。

$ oc apply -f operatorgroup.yaml

Subscription オブジェクトの YAML ファイルを作成し、namespace を Operator にサブスクライブします (例:

sub.yaml)。Subscription の例

apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: <operator_name> namespace: openshift-operators1 spec: channel: alpha name: <operator_name>2 source: redhat-operators3 sourceNamespace: openshift-marketplace4 Subscription オブジェクトを作成します。

$ oc apply -f sub.yamlこの時点で、OLM は選択した Operator を認識します。Operator の ClusterServiceVersion (CSV) はターゲット namespace に表示され、Operator で指定される API は作成用に利用可能になります。

追加リソース

第5章 Operator Lifecycle Manager でのプロキシーサポートの設定

グローバルプロキシーが OpenShift Container Platform クラスターで設定されている場合、Operator Lifecycle Manager はクラスター全体のプロキシーで管理する Operator を自動的に設定します。ただし、インストールされた Operator をグローバルプロキシーを上書きするか、またはカスタム CA 証明書を挿入するように設定することもできます。

追加リソース

- クラスター全体のプロキシーの設定

- カスタム PKI の設定 (カスタム CA 証明書)

5.1. Operator のプロキシー設定の上書き

クラスター全体の egress プロキシーが設定されている場合、Operator Lifecycle Manager (OLM) を使用して Operator から作成されるアプリケーションは Deployment および Pod でクラスター全体のプロキシー設定を継承します。クラスター管理者は、Operator の Subscription を設定してこれらのプロキシー設定を上書きすることもできます。

前提条件

-

cluster-adminパーミッションを持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできること。

手順

- Web コンソールで、Operators → OperatorHub ページに移動します。

- Operator を選択し、Install をクリックします。

Create Operator Subscription ページで、Subscription オブジェクトの YAML を変更して以下の環境変数を 1 つ以上

specセクションに組み込みます。-

HTTP_PROXY -

HTTPS_PROXY -

NO_PROXY

例:

プロキシー設定の上書きのある Subscription オブジェクト

apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: etcd-config-test namespace: openshift-operators spec: config: env: - name: HTTP_PROXY value: test_http - name: HTTPS_PROXY value: test_https - name: NO_PROXY value: test channel: clusterwide-alpha installPlanApproval: Automatic name: etcd source: community-operators sourceNamespace: openshift-marketplace startingCSV: etcdoperator.v0.9.4-clusterwideOLM はこれらの環境変数を単位として処理します。それらの環境変数が 1 つ以上設定されている場合、それらはすべて上書きされているものと見なされ、クラスター全体のデフォルト値はサブスクライブされた Operator の Deployment には使用されません。

-

- Subscribe をクリックし、Operator を選択された namespace で利用可能にします。

Operator の CSV が関連する namespace に表示されると、カスタムプロキシーの環境変数が Deployment に設定されていることを確認できます。たとえば、CLI を使用します。

$ oc get deployment -n openshift-operators etcd-operator -o yaml | grep -i "PROXY" -A 2 - name: HTTP_PROXY value: test_http - name: HTTPS_PROXY value: test_https - name: NO_PROXY value: test image: quay.io/coreos/etcd-operator@sha256:66a37fd61a06a43969854ee6d3e21088a98b93838e284a6086b13917f96b0d9c ...

追加リソース

- Operator のプロキシー設定を上書きする際の未設定の環境変数についての既知の問題 BZ#1751903 についての詳細は、OpenShift Container Platform 4.3 の『リリースノート』を参照してください。

5.2. カスタム CA 証明書の挿入

クラスター管理者が ConfigMap を使用してカスタム CA 証明書をクラスターに追加すると、Cluster Network Operator はユーザーによってプロビジョニングされる証明書およびシステム CA 証明書を単一バンドルにマージします。このマージされたバンドルを Operator Lifecycle Manager (OLM) で実行されている Operator に挿入することができます。これは、man-in-the-middle HTTPS プロキシーがある場合に役立ちます。

前提条件

-

cluster-adminパーミッションを持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできること。 - ConfigMap を使用してクラスターに追加されたカスタム CA 証明書。

- 必要な Operator が OLM にインストールされ、実行される。

手順

Operator の Subscription がある namespace に空の ConfigMap を作成し、以下のラベルを組み込みます。

apiVersion: v1 kind: ConfigMap metadata: name: trusted-ca1 labels: config.openshift.io/inject-trusted-cabundle: "true"2 この ConfigMap の作成後すぐに、ConfigMap にはマージされたバンドルの証明書の内容が設定されます。

Operator の Subscription オブジェクトを更新し、

trusted-caConfigMap をカスタム CA を必要とする Pod 内の各コンテナーにボリュームとしてマウントするspec.configセクションを追加します。kind: Subscription metadata: name: my-operator spec: package: etcd channel: alpha config:1 - selector: matchLabels: <labels_for_pods>2 volumes:3 - name: trusted-ca configMap: name: trusted-ca items: - key: ca-bundle.crt4 path: tls-ca-bundle.pem5 volumeMounts:6 - name: trusted-ca mountPath: /etc/pki/ca-trust/extracted/pem readOnly: true

第6章 クラスターからの Operator の削除

以下では、Web コンソールまたは CLI のいずれかを使用してクラスターから Operator を削除する方法について説明します。

6.1. Web コンソールの使用によるクラスターからの Operator の削除

クラスター管理者は Web コンソールを使用して、選択した namespace からインストールされた Operator を削除できます。

前提条件

-

cluster-adminパーミッションを持つアカウントを使用して OpenShift Container Platform クラスター Web コンソールにアクセスできること。

手順

- Operators → Installed Operators ページからスクロールするか、または Filter by name にキーワードを入力して必要な Operator を見つけます。次に、それをクリックします。

Operator Details ページの右側で、Actions ドロップダウンメニューから Uninstall Operator を選択します。

Uninstall Operator? ダイアログボックスが表示され、以下の内容が伝えられます。Operator を削除してもそのカスタムリソース定義または管理リソースは削除されません。Operator がクラスターにアプリケーションをデプロイしているか、またはクラスター外のリソースを設定している場合、それらは引き続き実行され、手動でクリーンアップする必要があります。

Operator、Operator デプロイメントおよび Pod はこのアクションで削除されます。CRD および CR を含む Operator によって管理されるリソースは削除されません。Web コンソールは、一部の Operator のダッシュボードおよびナビゲーションアイテムを有効にします。Operator のアンインストール後にこれらを削除するには、Operator CRD を手動で削除する必要があります。

- Uninstall を選択します。この Operator は実行を停止し、更新を受信しなくなります。

6.2. CLI の使用によるクラスターからの Operator の削除

クラスター管理者は CLI を使用して、選択した namespace からインストールされた Operator を削除できます。

前提条件

-

cluster-adminパーミッションを持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできること。 -

ocコマンドがワークステーションにインストールされていること。

手順

サブスクライブされた Operator (例:

jaeger) の現行バージョンをcurrentCSVフィールドで確認します。$ oc get subscription jaeger -n openshift-operators -o yaml | grep currentCSV currentCSV: jaeger-operator.v1.8.2Operator の Subscription (例:

jaeger) を削除します。$ oc delete subscription jaeger -n openshift-operators subscription.operators.coreos.com "jaeger" deleted直前の手順で

currentCSV値を使用し、ターゲット namespace の Operator の CSV を削除します。$ oc delete clusterserviceversion jaeger-operator.v1.8.2 -n openshift-operators clusterserviceversion.operators.coreos.com "jaeger-operator.v1.8.2" deleted

第7章 インストールされた Operator からのアプリケーションの作成

以下では、開発者を対象に、OpenShift Container Platform Web コンソールを使用して、インストールされた Operator からアプリケーションを作成する例を示します。

7.1. Operator を使用した etcd クラスターの作成

この手順では、Operator Lifecycle Manager (OLM) で管理される etcd Operator を使用した新規 etcd クラスターの作成について説明します。

前提条件

- OpenShift Container Platform 4.3 クラスターへのアクセス

- 管理者によってクラスターにすでにインストールされている etcd Operator

手順

- この手順を実行するために OpenShift Container Platform Web コンソールで新規プロジェクトを作成します。この例では、my-etcd というプロジェクトを使用します。

Operators → Installed Operators ページに移動します。クラスター管理者によってクラスターにインストールされ、使用可能にされた Operator が ClusterServiceVersion (CSV) の一覧としてここに表示されます。CSV は Operator によって提供されるソフトウェアを起動し、管理するために使用されます。

ヒント以下を使用して、CLI でこの一覧を取得できます。

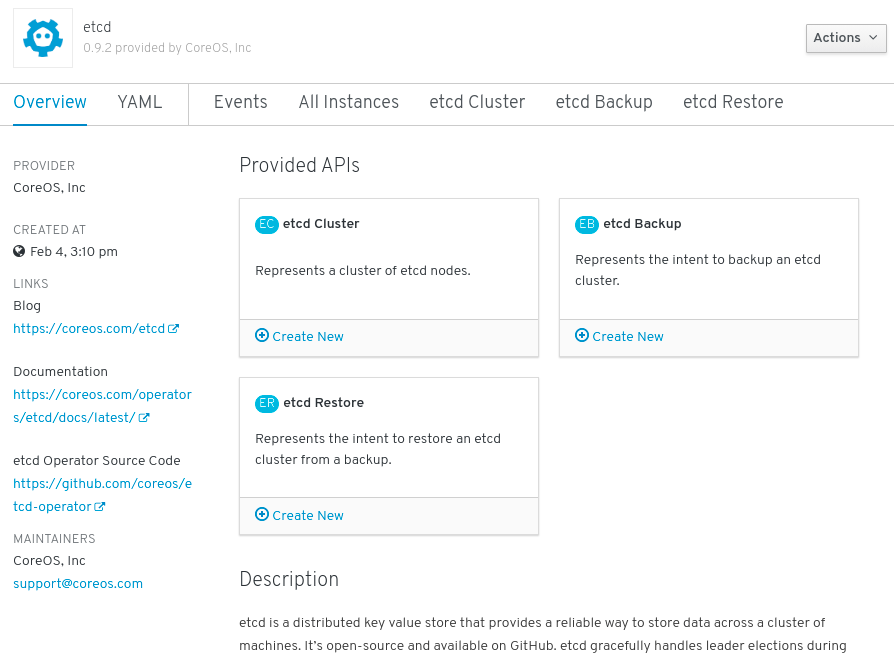

$ oc get csvInstalled Operators ページで、Copied をクリックしてから、etcd Operator をクリックして詳細情報および選択可能なアクションを表示します。

図7.1 etcd Operator の概要

Provided APIs に表示されているように、この Operator は 3 つの新規リソースタイプを利用可能にします。これには、etcd クラスター (

EtcdClusterリソース) のタイプが含まれます。これらのオブジェクトは、DeploymentsまたはReplicaSetsなどの組み込み済みのネイティブ Kubernetes オブジェクトと同様に機能しますが、これらには etcd を管理するための固有のロジックが含まれます。新規 etcd クラスターを作成します。

- etcd Cluster API ボックスで、Create New をクリックします。

-

次の画面では、クラスターのサイズなど

EtcdClusterオブジェクトのテンプレートを起動する最小条件への変更を加えることができます。ここでは Create をクリックして確定します。これにより、Operator がトリガーされ、Pod、サービス、および新規 etcd クラスターの他のコンポーネントが起動します。

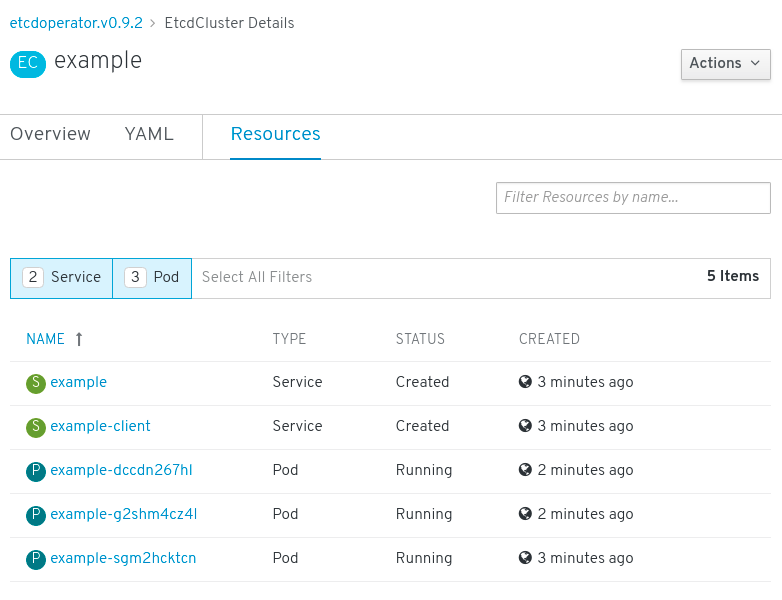

Resources タブをクリックして、プロジェクトに Operator によって自動的に作成され、設定された数多くのリソースが含まれることを確認します。

図7.2 etcd Operator リソース

Kubernetes サービスが作成され、プロジェクトの他の Pod からデータベースにアクセスできることを確認します。

所定プロジェクトで

editロールを持つすべてのユーザーは、クラウドサービスのようにセルフサービス方式でプロジェクトにすでに作成されている Operator によって管理されるアプリケーションのインスタンス (この例では etcd クラスター) を作成し、管理し、削除することができます。この機能を持つ追加のユーザーを有効にする必要がある場合、プロジェクト管理者は以下のコマンドを使用してこのロールを追加できます。$ oc policy add-role-to-user edit <user> -n <target_project>

これで、etcd クラスターは Pod が正常でなくなったり、クラスターのノード間で移行する際の障害に対応し、データのリバランスを行います。最も重要な点として、適切なアクセスを持つクラスター管理者または開発者は独自のアプリケーションでデータベースを簡単に使用できるようになります。

第8章 Operator ステータスの表示

Operator Lifecycle Manager (OLM) のシステムの状態を理解することは、インストールされた Operator についての問題について意思決定を行い、デバッグを行う上で重要です。OLM は、Subscription およびそれに関連するカタログソースリソースの状態および実行されたアクションに関する知見を提供します。これは、それぞれの Operator の正常性を把握するのに役立ちます。

8.1. 条件のタイプ

Subscription は状態についての以下のタイプを報告します。

| 状態 | 説明 |

|---|---|

|

| 解決に使用される一部のまたはすべてのカタログソースは正常ではありません。 |

|

| Subscription の InstallPlan がありません。 |

|

| Subscription の InstallPlan のインストールが保留中です。 |

|

| Subscription の InstallPlan が失敗しました。 |

8.2. CLI を使用した Operator ステータスの表示

CLI を使用して Operator ステータスを表示できます。

手順

oc describeコマンドを使用して、Subscription のリソースを検査します。$ oc describe sub <subscription_name>コマンド出力で

Conditionsセクションを見つけます。Conditions: Last Transition Time: 2019-07-29T13:42:57Z Message: all available catalogsources are healthy Reason: AllCatalogSourcesHealthy Status: False Type: CatalogSourcesUnhealthy

第9章 Operator のインストールおよびアップグレードについてのポリシーの作成

Operator の実行には幅広い権限が必要になる可能性があり、必要な権限はバージョン間で異なる場合があります。Operator Lifecycle Manager (OLM) は、cluster-admin 権限で実行されます。デフォルトで、Operator の作成者は ClusterServiceVersion (CSV) で任意のパーミッションのセットを指定でき、OLM はこれを Operator に付与します。

クラスター管理者は、Operator がクラスタースコープの権限を実行できず、ユーザーが OLM を使用して権限をエスカレートできないようにするよう対策を取る必要があります。これを制限する方法として、クラスター管理者は Operator をクラスターに追加される前に監査する必要があります。また、クラスター管理者には、サービスアカウントを使用した Operator のインストールまたはアップグレード時に許可されるアクションを判別し、制限するための各種ツールが提供されます。

OperatorGroup を、その権限のセットが付与されたサービスアカウントセットに関連付けることにより、クラスター管理者は Operator にポリシーを設定して、それらが RBAC ルールを使用して事前に決定された境界内でのみ動作するようにできます。Operator は、それらのルールによって明示的に許可されていないことはいずれも実行できません。

クラスター管理者以外のユーザーによるこの自己完結型の、スコープが制限された Operator のインストールによって、より多くのユーザーがさらに多くの Operator Framework ツールを利用でき、Operator によるアプリケーションのビルドのエクスペリエンスが強化されます。

9.1. Operator インストールポリシーについて

OLM を使用すると、クラスター管理者は OperatorGroup に関連付けられたすべての Operator がデプロイされ、サービスアカウントに付与される権限に基づいてデプロイされ、実行されるように OperatorGroup のサービスアカウントを指定できます。

APIService および CustomResourceDefinition リソースは、cluster-admin ロールを使用して OLM によって常に作成されます。OperatorGroup に関連付けられたサービスアカウントには、これらのリソースを作成するための権限を付与できません。

指定したサービスアカウントがインストールまたはアップグレードされる Operator についての適切なパーミッションを持たない場合、便利なコンテキスト情報がそれぞれのリソースのステータスに追加されます。これにより、管理者が問題のトラブルシューティングおよび解決が容易になります。

この OperatorGroup に関連付けられる Operator は、指定されたサービスアカウントに付与されるパーミッションに制限されます。Operator がサービスアカウントの範囲外のパーミッションを要求する場合、インストールは適切なエラーを出して失敗します。

9.1.1. インストールシナリオ

Operator をクラスターでインストールまたはアップグレードできるかどうかを決定する際に、OLM は以下のシナリオを検討します。

- クラスター管理者は新規の OperatorGroup を作成し、サービスアカウントを指定します。この OperatorGroup に関連付けられるすべての Operator がサービスアカウントに付与される権限に基づいてインストールされ、実行されます。

- クラスター管理者は新規の OperatorGroup を作成し、サービスアカウントを指定しません。OpenShift Container Platform は後方互換性を維持します。そのため、デフォルト動作はそのまま残り、Operator のインストールおよびアップグレードは許可されます。

- サービスアカウントを指定しない既存の OperatorGroup の場合、デフォルトの動作は残り、Operator のインストールおよびアップグレードは許可されます。

- クラスター管理者は既存の OperatorGroup を更新し、サービスアカウントを指定します。OLM により、既存の Operator は現在の権限で継続して実行されます。このような既存 Operator がアップグレードされる場合、これは再インストールされ、新規 Operator のようにサービスアカウントに付与される権限に基づいて実行されます。

- OperatorGroup で指定されるサービスアカウントは、パーミッションの追加または削除によって変更されるか、または既存のサービスアカウントは新しいサービスアカウントに切り替わります。既存の Operator がアップグレードされる場合、これは再インストールされ、新規 Operator のように更新されたサービスアカウントに付与される権限に基づいて実行されます。

- クラスター管理者は、サービスアカウントを OperatorGroup から削除します。デフォルトの動作は残り、Operator のインストールおよびアップグレードは許可されます。

9.1.2. インストールワークフロー

OperatorGroup がサービスアカウントに関連付けられ、Operator がインストールまたはアップグレードされると、OLM は以下のワークフローを使用します。

- 指定された Subscription オブジェクトは OLM によって選択されます。

- OLM はこの Subscription に関連する OperatorGroup をフェッチします。

- OLM は OperatorGroup にサービスアカウントが指定されていることを判別します。

- OLM はサービスアカウントにスコープが設定されたクライアントを作成し、スコープ設定されたクライアントを使用して Operator をインストールします。これにより、Operator で要求されるパーミッションは常に OperatorGroup のそのサービスアカウントのパーミッションに制限されるようになります。

- OLM は CSV で指定されたパーミッションセットを使用して新規サービスアカウントを作成し、これを Operator に割り当てます。Operator は割り当てられたサービスアカウントで実行されます。

9.2. Operator インストールのスコープ設定

Operator の OLM でのインストールおよびアップグレードについてのスコープ設定ルールを提供するには、サービスアカウントを OperatorGroup に関連付けます。

この例では、クラスター管理者は一連の Operator を指定された namespace に制限できます。

手順

新規の namespace を作成します。

$ cat <<EOF | oc create -f - apiVersion: v1 kind: Namespace metadata: name: scoped EOFOperator を制限する必要のあるパーミッションを割り当てます。これには、新規サービスアカウント、関連するロール、およびロールバインディングの作成が必要になります。

$ cat <<EOF | oc create -f - apiVersion: v1 kind: ServiceAccount metadata: name: scoped namespace: scoped EOF以下の例では、単純化するために、サービスアカウントに対し、指定される namespace ですべてのことを実行できるパーミッションを付与します。実稼働環境では、より粒度の細かいパーミッションセットを作成する必要があります。

$ cat <<EOF | oc create -f - apiVersion: rbac.authorization.k8s.io/v1 kind: Role metadata: name: scoped namespace: scoped rules: - apiGroups: ["*"] resources: ["*"] verbs: ["*"] --- apiVersion: rbac.authorization.k8s.io/v1 kind: RoleBinding metadata: name: scoped-bindings namespace: scoped roleRef: apiGroup: rbac.authorization.k8s.io kind: Role name: scoped subjects: - kind: ServiceAccount name: scoped namespace: scoped EOF指定された namespace に OperatorGroup を作成します。この OperatorGroup は指定された namespace をターゲットにし、そのテナンシーがこれに制限されるようにします。さらに、OperatorGroup はユーザーがサービスアカウントを指定できるようにします。直前の手順で作成した ServiceAccount を指定します。

$ cat <<EOF | oc create -f - apiVersion: operators.coreos.com/v1 kind: OperatorGroup metadata: name: scoped namespace: scoped spec: serviceAccountName: scoped targetNamespaces: - scoped EOF指定された namespace にインストールされる Operator はこの OperatorGroup に関連付けられ、指定されるサービスアカウントに関連付けられます。

指定された namespace で Subscription を作成し、Operator をインストールします。

$ cat <<EOF | oc create -f - apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: etcd namespace: scoped spec: channel: singlenamespace-alpha name: etcd source: <catalog_source_name>1 sourceNamespace: <catalog_source_namespace>2 EOFこの OperatorGroup に関連付けられる Operator は、指定されたサービスアカウントに付与されるパーミッションに制限されます。Operator がサービスアカウントの範囲外のパーミッションを要求する場合、インストールは該当するエラーを出して失敗します。

9.2.1. 粒度の細かいパーミッション

OLM は OperatorGroup で指定されたサービスアカウントを使用して、インストールされる Operator に関連する以下のリソースを作成または更新します。

- ClusterServiceVersion

- Subscription

- Secret

- ServiceAccount

- Service

- ClusterRole および ClusterRoleBinding

- Role および RoleBinding

Operator を指定された namespace に制限するため、クラスター管理者は以下のパーミッションをサービスアカウントに付与して起動できます。

以下のロールは一般的なサンプルであり、特定の Operator に基づいて追加のルールが必要になる可能性があります。

kind: Role

rules:

- apiGroups: ["operators.coreos.com"]

resources: ["subscriptions", "clusterserviceversions"]

verbs: ["get", "create", "update", "patch"]

- apiGroups: [""]

resources: ["services", "serviceaccounts"]

verbs: ["get", "create", "update", "patch"]

- apiGroups: ["rbac.authorization.k8s.io"]

resources: ["roles", "rolebindings"]

verbs: ["get", "create", "update", "patch"]

- apiGroups: ["apps"]

resources: ["deployments"]

verbs: ["list", "watch", "get", "create", "update", "patch", "delete"]

- apiGroups: [""]

resources: ["pods"]

verbs: ["list", "watch", "get", "create", "update", "patch", "delete"]さらに、Operator がプルシークレットを指定する場合、以下のパーミッションも追加する必要があります。

kind: ClusterRole

rules:

- apiGroups: [""]

resources: ["secrets"]

verbs: ["get"]

---

kind: Role

rules:

- apiGroups: [""]

resources: ["secrets"]

verbs: ["create", "update", "patch"]- 1

- シークレットを OLM namespace から取得するために必要です。

9.3. パーミッションに関する失敗のトラブルシューティング

パーミッションがないために Operator のインストールが失敗する場合は、以下の手順を使用してエラーを特定します。

手順

Subscription オブジェクトを確認します。このステータスには、Operator の必要な ClusterRole、 ClusterRoleBinding、Role、および RoleBinding の作成を試行した InstallPlan オブジェクトをポイントするオブジェクト参照

installPlanRefがあります。apiVersion: operators.coreos.com/v1 kind: Subscription metadata: name: etcd namespace: scoped status: installPlanRef: apiVersion: operators.coreos.com/v1 kind: InstallPlan name: install-4plp8 namespace: scoped resourceVersion: "117359" uid: 2c1df80e-afea-11e9-bce3-5254009c9c23InstallPlan オブジェクトのステータスでエラーの有無を確認します。

apiVersion: operators.coreos.com/v1 kind: InstallPlan status: conditions: - lastTransitionTime: "2019-07-26T21:13:10Z" lastUpdateTime: "2019-07-26T21:13:10Z" message: 'error creating clusterrole etcdoperator.v0.9.4-clusterwide-dsfx4: clusterroles.rbac.authorization.k8s.io is forbidden: User "system:serviceaccount:scoped:scoped" cannot create resource "clusterroles" in API group "rbac.authorization.k8s.io" at the cluster scope' reason: InstallComponentFailed status: "False" type: Installed phase: Failedエラーメッセージは、以下を示しています。

-

リソースの API グループを含む、作成に失敗したリソースのタイプ。この場合、これは

rbac.authorization.k8s.ioグループのclusterrolesです。 - リソースの名前。

-

エラーのタイプ:

is forbiddenは、ユーザーに操作を実行するための十分なパーミッションがないことを示します。 - リソースの作成または更新を試みたユーザーの名前。この場合、これは OperatorGroup で指定されたサービスアカウントを参照します。

操作の範囲が

cluster scopeかどうか。ユーザーは、不足しているパーミッションをサービスアカウントに追加してから、繰り返すことができます。

注記現在、OLM は最初の試行でエラーの詳細の一覧を提供しませんが、今後のリリースで追加される可能性があります。

-

リソースの API グループを含む、作成に失敗したリソースのタイプ。この場合、これは

第10章 ネットワークが制限された環境での Operator Lifecycle Manager の使用

OpenShift Container Platform がネットワークが制限された環境 (非接続クラスターとしても知られる) にインストールされている場合、Operator Lifecycle Manager (OLM) では、デフォルトの OperatorHub ソースでは完全なインターネット接続が必要であるため、デフォルトの OperatorHub ソースを使用できなくなります。クラスター管理者はこれらのデフォルトソースを無効にして、ローカルミラーを作成し、OLM がローカルソースから Operator をインストールし、管理するようにできます。

OLM はローカルソースから Operator を管理できますが、指定された Operator がネットワークが制限された環境で正常に実行されるかどうかは Operator 自体に依存します。以下は、Operator の特長です。

-

関連するイメージ、または Operator がそれらの機能を実行するために必要となる可能性のある他のコンテナーイメージを ClusterServiceVersion (CSV) オブジェクトの

relatedImagesパラメーターで一覧表示します。 - 指定されたすべてのイメージを、タグではなくダイジェスト (SHA) で参照します。

非接続モードでの実行をサポートする Red Hat Operator の一覧については、以下の Red Hat ナレッジベースの記事を参照してください。

10.1. Operator カタログイメージについて

Operator Lifecycle Manager (OLM) は常に Operator カタログの最新バージョンから Operator をインストールします。OpenShift Container Platform 4.3 の時点で、Red Hat が提供する Operator は、quay.io から Quay App Registry カタログ経由で配布されます。

| カタログ | 説明 |

|---|---|

|

| Red Hat によってパッケージ化され、出荷される Red Hat 製品のパブリックカタログ。Red Hat によってサポートされます。 |

|

| 大手独立系ソフトウェアベンダー (ISV) の製品のパブリックカタログ。Red Hat は ISV とのパートナーシップにより、パッケージ化および出荷を行います。ISV によってサポートされます。 |

|

| operator-framework/community-operators GitHub リポジトリーで関連するエンティティーによってメンテナンスされる、オプションで表示可能になるソフトウェアのパブリックカタログ。正式なサポートはありません。 |

カタログが更新されると、Operator の最新バージョンが変更され、それ以前のバージョンが削除または変更される可能性があります。この動作により、再現可能なインストールを維持することが徐々に難しくなる可能性があります。さらに OLM がネットワークが制限された環境の OpenShift Container Platform クラスターで実行される場合、quay.io からカタログに直接アクセスすることはできません。

oc adm catalog build コマンドを使用して、クラスター管理者は Operator カタログイメージを作成できます。以下は Operator カタログイメージの説明です。

- App Registry タイプカタログのコンテンツの特定の時点のエクスポート。

- App Registry カタログをコンテナーイメージタイプカタログに変換した結果。

- イミュータブルなアーティファクト。

Operator カタログイメージを作成する方法は、前述の問題を引き起こさずにこのコンテンツを使用できる簡単な方法です。

10.2. Operator カタログイメージのビルド

クラスター管理者は、Operator Lifecycle Manager (OLM) によって使用されるカスタム Operator カタログイメージをビルドし、Docker v2-2 をサポートするコンテナーイメージレジストリーにそのイメージをプッシュできます。ネットワークが制限された環境のクラスターの場合、このレジストリーには、ネットワークが制限されたインストールで作成されたミラーレジストリーなど、クラスターにネットワークアクセスのあるレジストリーを使用できます。

OpenShift Container Platform クラスターの内部レジストリーはターゲットレジストリーとして使用できません。これは、ミラーリングプロセスで必要となるタグを使わないプッシュをサポートしないためです。

以下の例では、お使いのネットワークとインターネットの両方にアクセスできるミラーレジストリーを使用することを前提としています。

前提条件

- ネットワークアクセスが無制限の Linux ワークステーション[1]

-

ocversion 4.3.5+ -

podmanversion 1.4.4+ - Docker v2-2 をサポートするミラーレジストリーへのアクセス

プライベートレジストリーを使用している場合、後続の手順で使用するために

REG_CREDS環境変数をレジストリー認証情報のファイルパスに設定します。たとえばpodmanCLI の場合は、以下のようになります。$ REG_CREDS=${XDG_RUNTIME_DIR}/containers/auth.jsonquay.io アカウントがアクセスできるプライベート namespace を使用している場合、Quay 認証トークンを設定する必要があります。quay.io 認証情報を使用してログイン API に対して要求を行うことにより、

--auth-tokenフラグで使用できるAUTH_TOKEN環境変数を設定します。$ AUTH_TOKEN=$(curl -sH "Content-Type: application/json" \ -XPOST https://quay.io/cnr/api/v1/users/login -d ' { "user": { "username": "'"<quay_username>"'", "password": "'"<quay_password>"'" } }' | jq -r '.token')

手順

ネットワークアクセスが無制限のワークステーションで、ターゲットミラーレジストリーを使用して認証を行います。

$ podman login <registry_host_name>また、ビルド時にベースイメージをプルできるように、

registry.redhat.ioで認証します。$ podman login registry.redhat.ioquay.ioから

redhat-operatorsカタログをベースにカタログイメージをビルドし、そのイメージにタグを付け、ミラーレジストリーにプッシュします。$ oc adm catalog build \ --appregistry-org redhat-operators \1 --from=registry.redhat.io/openshift4/ose-operator-registry:v4.3 \2 --filter-by-os="linux/amd64" \3 --to=<registry_host_name>:<port>/olm/redhat-operators:v1 \4 [-a ${REG_CREDS}] \5 [--insecure] \6 [--auth-token "${AUTH_TOKEN}"]7 INFO[0013] loading Bundles dir=/var/folders/st/9cskxqs53ll3wdn434vw4cd80000gn/T/300666084/manifests-829192605 ... Pushed sha256:f73d42950021f9240389f99ddc5b0c7f1b533c054ba344654ff1edaf6bf827e3 to example_registry:5000/olm/redhat-operators:v1- 1

- App Registry インスタンスからのプルに使用する組織 (namespace)。

- 2

- ターゲット OpenShift Container Platform クラスターのメジャーバージョンおよびマイナーバージョンに一致するタグを使用して、

--fromをose-operator-registryベースイメージに設定します。 - 3

--filter-by-osを、ターゲットの OpenShift Container Platform クラスターと一致する必要のある、ベースイメージに使用するオペレーティングシステムおよびアーキテクチャーに設定します。使用できる値は、linux/amd64、linux/ppc64le、およびlinux/s390xです。- 4

- カタログイメージに名前を付け、

v1などのタグを追加します。 - 5

- オプション: 必要な場合は、レジストリー認証情報ファイルの場所を指定します。

- 6

- オプション: ターゲットレジストリーの信頼を設定しない場合は、

--insecureフラグを追加します。 - 7

- オプション: 公開されていない他のアプリケーションレジストリーカタログが使用されている場合、Quay 認証トークンを指定します。

無効なマニフェストが Red Hat のカタログに誤って導入される可能性があります。これが実際に生じる場合には、以下のようなエラーが表示される可能性があります。

... INFO[0014] directory dir=/var/folders/st/9cskxqs53ll3wdn434vw4cd80000gn/T/300666084/manifests-829192605 file=4.2 load=package W1114 19:42:37.876180 34665 builder.go:141] error building database: error loading package into db: fuse-camel-k-operator.v7.5.0 specifies replacement that couldn't be found Uploading ... 244.9kB/s通常、これらのエラーは致命的なエラーではなく、該当する Operator パッケージにインストールする予定の Operator やその依存関係が含まれない場合、それらを無視することができます。

10.3. ネットワークが制限された環境向けの OperatorHub の設定

クラスター管理者は、カスタム Operator カタログイメージを使用し、OLM および OperatorHub をネットワークが制限された環境でローカルコンテンツを使用するように設定できます。この例では、以前にビルドされ、サポートされているレジストリーにプッシュされたカスタム redhat-operators カタログイメージを使用します。

前提条件

- ネットワークアクセスが無制限の Linux ワークステーション [1]

- サポートされているレジストリーにプッシュされるカスタム Operator カタログイメージ

-

ocversion 4.3.5+ -

podmanversion 1.4.4+ - Docker v2-2 をサポートするミラーレジストリーへのアクセス

プライベートレジストリーを使用している場合、後続の手順で使用するために

REG_CREDS環境変数をレジストリー認証情報のファイルパスに設定します。たとえばpodmanCLI の場合は、以下のようになります。$ REG_CREDS=${XDG_RUNTIME_DIR}/containers/auth.json

手順

disableAllDefaultSources: trueを仕様に追加してデフォルトの OperatorSource を無効にします。$ oc patch OperatorHub cluster --type json \ -p '[{"op": "add", "path": "/spec/disableAllDefaultSources", "value": true}]'これにより、OpenShift Container Platform のインストール時にデフォルトで設定されるデフォルトの OperatorSource が無効になります。

oc adm catalog mirrorコマンドは、カスタム Operator カタログイメージのコンテンツを抽出し、ミラーリングに必要なマニフェストを生成します。以下のいずれかを選択できます。- コマンドのデフォルト動作で、マニフェストの生成後にすべてのイメージコンテンツをミラーレジストリーに自動的にミラーリングできるようにします。または、

-

--manifests-onlyフラグを追加して、ミラーリングに必要なマニフェストのみを生成しますが、これにより、イメージコンテンツがレジストリーに自動的にミラーリングされる訳ではありません。これは、ミラーリングする内容を確認するのに役立ちます。また、コンテンツのサブセットのみが必要な場合に、マッピングの一覧に変更を加えることができます。次に、そのファイルをoc image mirrorコマンドで使用し、後のステップでイメージの変更済みの一覧をミラーリングできます。

ネットワークアクセスが無制限のワークステーションで、以下のコマンドを実行します。

$ oc adm catalog mirror \ <registry_host_name>:<port>/olm/redhat-operators:v1 \1 <registry_host_name>:<port> \ [-a ${REG_CREDS}] \2 [--insecure] \3 [--filter-by-os="<os>/<arch>"] \4 [--manifests-only]5 - 1

- Operator カタログイメージを指定します。

- 2

- オプション: 必要な場合は、レジストリー認証情報ファイルの場所を指定します。

- 3

- オプション: ターゲットレジストリーの信頼を設定しない場合は、

--insecureフラグを追加します。 - 4

- オプション: カタログは複数のアーキテクチャーおよびオペレーティングシステムをサポートするイメージを参照する可能性があるため、アーキテクチャーおよびオペレーティングシステムでフィルターして、一 致するイメージのみをミラーリングするようにできます。使用できる値は、

linux/amd64、linux/ppc64le、およびlinux/s390xです。 - 5

- オプション: ミラーリングに必要なマニフェストのみを生成し、実際にはイメージコンテンツをレジストリーにミラーリングしません。

出力例

using database path mapping: /:/tmp/190214037 wrote database to /tmp/190214037 using database at: /tmp/190214037/bundles.db1 ...- 1

- コマンドで生成される一時的なデータベース。

コマンドの実行後に、

<image_name>-manifests/ディレクトリーが現在のディレクトリーに作成され、以下のファイルが生成されます。-

これにより、

imageContentSourcePolicy.yamlファイルは ImageContentSourcePolicy オブジェクトを定義します。このオブジェクトは、このオブジェクトは、ノードを Operator マニフェストおよびミラーリングされたレジストリーに保存されるイメージ参照間で変換できるように設定します。 -

mapping.txtファイルには、すべてのソースイメージが含まれ、これはそれらのイメージをターゲットレジストリー内のどこにマップするかを示します。このファイルはoc image mirrorコマンドと互換性があり、ミラーリング設定をさらにカスタマイズするために使用できます。

直前の手順で

--manifests-onlyフラグを使用して、コンテンツのサブセットのみをミラーリングする場合は、以下を実行します。mapping.txtファイルのイメージの一覧を仕様に変更します。ミラーリングするイメージのサブセットの名前とバージョンが不明な場合は、以下の手順で確認します。oc adm catalog mirrorコマンドで生成された一時的なデータベースに対してsqlite3ツールを実行し、一般的な検索クエリーに一致するイメージの一覧を取得します。出力は、後にmapping.txtファイルを編集する方法を通知するのに役立ちます。たとえば、

clusterlogging.4.3の文字列のようなイメージの一覧を取得するには、以下を実行します。$ echo "select * from related_image \ where operatorbundle_name like 'clusterlogging.4.3%';" \ | sqlite3 -line /tmp/190214037/bundles.db1 - 1

oc adm catalog mirrorコマンドの直前の出力を参照し、データベースファイルのパスを見つけます。

出力例

image = registry.redhat.io/openshift4/ose-logging-kibana5@sha256:aa4a8b2a00836d0e28aa6497ad90a3c116f135f382d8211e3c55f34fb36dfe61 operatorbundle_name = clusterlogging.4.3.33-202008111029.p0 image = registry.redhat.io/openshift4/ose-oauth-proxy@sha256:6b4db07f6e6c962fc96473d86c44532c93b146bbefe311d0c348117bf759c506 operatorbundle_name = clusterlogging.4.3.33-202008111029.p0 ...直前の手順で取得した結果を使用して

mapping.txtファイルを編集し、ミラーリングする必要のあるイメージのサブセットのみを追加します。たとえば、前述の出力例の

image値を使用して、mapping.txtファイルに以下の一致する行が存在することを確認できます。mapping.txtの一致するイメージマッピング。registry.redhat.io/openshift4/ose-logging-kibana5@sha256:aa4a8b2a00836d0e28aa6497ad90a3c116f135f382d8211e3c55f34fb36dfe61=<registry_host_name>:<port>/openshift4-ose-logging-kibana5:a767c8f0 registry.redhat.io/openshift4/ose-oauth-proxy@sha256:6b4db07f6e6c962fc96473d86c44532c93b146bbefe311d0c348117bf759c506=<registry_host_name>:<port>/openshift4-ose-oauth-proxy:3754ea2bこの例では、これらのイメージのみをミラーリングする場合に、

mapping.txtファイルの他のすべてのエントリーを削除し、上記の 2 行のみを残します。

ネットワークアクセスが無制限のワークステーション上で、変更した

mapping.txtファイルを使用し、oc image mirrorコマンドを使用してイメージをレジストリーにミラーリングします。$ oc image mirror \ [-a ${REG_CREDS}] \ -f ./redhat-operators-manifests/mapping.txt

ImageContentSourcePolicy を適用します。

$ oc apply -f ./redhat-operators-manifests/imageContentSourcePolicy.yamlカタログイメージを参照する CatalogSource オブジェクトを作成します。

仕様を以下のように変更し、これを

catalogsource.yamlファイルとして保存します。apiVersion: operators.coreos.com/v1alpha1 kind: CatalogSource metadata: name: my-operator-catalog namespace: openshift-marketplace spec: sourceType: grpc image: <registry_host_name>:<port>/olm/redhat-operators:v11 displayName: My Operator Catalog publisher: grpc- 1

- Operator カタログイメージを指定します。

このファイルを使用して CatalogSource オブジェクトを作成します。

$ oc create -f catalogsource.yaml

以下のリソースが正常に作成されていることを確認します。

Pod を確認します。

$ oc get pods -n openshift-marketplace出力例

NAME READY STATUS RESTARTS AGE my-operator-catalog-6njx6 1/1 Running 0 28s marketplace-operator-d9f549946-96sgr 1/1 Running 0 26hCatalogSource を確認します。

$ oc get catalogsource -n openshift-marketplace出力例

NAME DISPLAY TYPE PUBLISHER AGE my-operator-catalog My Operator Catalog grpc 5sPackageManifest を確認します。

$ oc get packagemanifest -n openshift-marketplace出力例

NAME CATALOG AGE etcd My Operator Catalog 34s

ネットワークが制限された環境の OpenShift Container Platform クラスター Web コンソールで、OperatorHub ページから Operator をインストールできます。

10.4. Operator カタログイメージの更新

クラスター管理者がカスタム Operator カタログイメージを使用するように OperatorHub を設定した後、管理者は Red Hat の App Registry カタログに追加された更新をキャプチャーして、OpenShift Container Platform クラスターを最新の Operator と共に最新の状態に保つことができます。これは、新規 Operator カタログイメージをビルドし、プッシュしてから、既存の CatalogSource の spec.image パラメーターを新規イメージダイジェストに置き換えることによって実行されます。

この例では、カスタムの redhat-operators カタログイメージが OperatorHub と使用するように設定されていることを前提としています。

前提条件

- ネットワークアクセスが無制限の Linux ワークステーション [1]

-

ocversion 4.3.5+ -

podmanversion 1.4.4+ - Docker v2-2 をサポートするミラーレジストリーへのアクセス

- カスタムカタログイメージを使用するように設定されている OperatorHub

プライベートレジストリーを使用している場合、後続の手順で使用するために

REG_CREDS環境変数をレジストリー認証情報のファイルパスに設定します。たとえばpodmanCLI の場合は、以下のようになります。$ REG_CREDS=${XDG_RUNTIME_DIR}/containers/auth.jsonquay.io アカウントがアクセスできるプライベート namespace を使用している場合、Quay 認証トークンを設定する必要があります。quay.io 認証情報を使用してログイン API に対して要求を行うことにより、

--auth-tokenフラグで使用できるAUTH_TOKEN環境変数を設定します。$ AUTH_TOKEN=$(curl -sH "Content-Type: application/json" \ -XPOST https://quay.io/cnr/api/v1/users/login -d ' { "user": { "username": "'"<quay_username>"'", "password": "'"<quay_password>"'" } }' | jq -r '.token')

手順

ネットワークアクセスが無制限のワークステーションで、ターゲットミラーレジストリーを使用して認証を行います。

$ podman login <registry_host_name>また、ビルド時にベースイメージをプルできるように、

registry.redhat.ioで認証します。$ podman login registry.redhat.ioquay.ioから

redhat-operatorsカタログをベースに新規カタログイメージをビルドし、そのイメージにタグを付け、ミラーレジストリーにプッシュします。$ oc adm catalog build \ --appregistry-org redhat-operators \1 --from=registry.redhat.io/openshift4/ose-operator-registry:v4.3 \2 --filter-by-os="linux/amd64" \3 --to=<registry_host_name>:<port>/olm/redhat-operators:v2 \4 [-a ${REG_CREDS}] \5 [--insecure] \6 [--auth-token "${AUTH_TOKEN}"]7 INFO[0013] loading Bundles dir=/var/folders/st/9cskxqs53ll3wdn434vw4cd80000gn/T/300666084/manifests-829192605 ... Pushed sha256:f73d42950021f9240389f99ddc5b0c7f1b533c054ba344654ff1edaf6bf827e3 to example_registry:5000/olm/redhat-operators:v2- 1

- App Registry インスタンスからのプルに使用する組織 (namespace)。

- 2

- ターゲット OpenShift Container Platform クラスターのメジャーバージョンおよびマイナーバージョンに一致するタグを使用して、

--fromをose-operator-registryベースイメージに設定します。 - 3

--filter-by-osを、ターゲットの OpenShift Container Platform クラスターと一致する必要のある、ベースイメージに使用するオペレーティングシステムおよびアーキテクチャーに設定します。使用できる値は、linux/amd64、linux/ppc64le、およびlinux/s390xです。- 4

- カタログイメージに名前を付け、タグを追加します (更新済みのカタログの場合は

v2などのタグ)。 - 5

- オプション: 必要な場合は、レジストリー認証情報ファイルの場所を指定します。

- 6

- オプション: ターゲットレジストリーの信頼を設定しない場合は、

--insecureフラグを追加します。 - 7

- オプション: 公開されていない他のアプリケーションレジストリーカタログが使用されている場合、Quay 認証トークンを指定します。

カタログのコンテンツをターゲットレジストリーに対してミラーリングします。以下の

oc adm catalog mirrorコマンドは、カスタム Operator カタログイメージのコンテンツを抽出し、ミラーリングに必要なマニフェストを生成し、イメージをレジストリーにミラーリングします。$ oc adm catalog mirror \ <registry_host_name>:<port>/olm/redhat-operators:v2 \1 <registry_host_name>:<port> \ [-a ${REG_CREDS}] \2 [--insecure] \3 [--filter-by-os="<os>/<arch>"]4 mirroring ...- 1

- 新規の Operator カタログイメージを指定します。

- 2

- オプション: 必要な場合は、レジストリー認証情報ファイルの場所を指定します。

- 3

- オプション: ターゲットレジストリーの信頼を設定しない場合は、

--insecureフラグを追加します。 - 4

- オプション: カタログは複数のアーキテクチャーおよびオペレーティングシステムをサポートするイメージを参照する可能性があるため、アーキテクチャーおよびオペレーティングシステムでフィルターして、一 致するイメージのみをミラーリングするようにできます。使用できる値は、

linux/amd64、linux/ppc64le、およびlinux/s390xです。

新たに生成されたマニフェストを適用します。

$ oc apply -f ./redhat-operators-manifests重要imageContentSourcePolicy.yamlマニフェストを適用する必要がない場合があります。ファイルのdiffを完了して、変更が必要かどうかを判断します。カタログイメージを参照する CatalogSource オブジェクトを更新します。

この CatalogSource の元の

catalogsource.yamlファイルがある場合:catalogsource.yamlファイルを編集し、spec.imageフィールドで新規カタログイメージを参照できるようにします。apiVersion: operators.coreos.com/v1alpha1 kind: CatalogSource metadata: name: my-operator-catalog namespace: openshift-marketplace spec: sourceType: grpc image: <registry_host_name>:<port>/olm/redhat-operators:v21 displayName: My Operator Catalog publisher: grpc- 1

- 新規の Operator カタログイメージを指定します。

更新されたファイルを使用して CatalogSource オブジェクトを置き換えます。

$ oc replace -f catalogsource.yaml

または、以下のコマンドを使用して CatalogSource を編集し、

spec.imageパラメーターで新規カタログイメージを参照します。$ oc edit catalogsource <catalog_source_name> -n openshift-marketplace

更新された Operator は、OpenShift Container Platform クラスターの OperatorHub ページから利用できるようになりました。

10.5. Operator カタログイメージのテスト

Operator カタログイメージのコンテンツは、これをコンテナーとして実行し、gRPC API をクエリーして検証できます。イメージをさらにテストするには、CatalogSource でイメージを参照して OLM サブスクリプションを解決できます。この例では、以前にビルドされ、サポートされているレジストリーにプッシュされたカスタム redhat-operators カタログイメージを使用します。

前提条件

- サポートされているレジストリーにプッシュされるカスタム Operator カタログイメージ

-

podmanversion 1.4.4+ -

ocversion 4.3.5+ - Docker v2-2 をサポートするミラーレジストリーへのアクセス

-

grpcurl

手順

Operator カタログイメージをプルします。

$ podman pull <registry_host_name>:<port>/olm/redhat-operators:v1イメージを実行します。

$ podman run -p 50051:50051 \ -it <registry_host_name>:<port>/olm/redhat-operators:v1grpcurlを使用して利用可能なパッケージの実行中のイメージをクエリーします。$ grpcurl -plaintext localhost:50051 api.Registry/ListPackages { "name": "3scale-operator" } { "name": "amq-broker" } { "name": "amq-online" }チャネルの最新の Operator バンドルを取得します。

$ grpcurl -plaintext -d '{"pkgName":"kiali-ossm","channelName":"stable"}' localhost:50051 api.Registry/GetBundleForChannel { "csvName": "kiali-operator.v1.0.7", "packageName": "kiali-ossm", "channelName": "stable", ...イメージのダイジェストを取得します。

$ podman inspect \ --format='{{index .RepoDigests 0}}' \ <registry_host_name>:<port>/olm/redhat-operators:v1 example_registry:5000/olm/redhat-operators@sha256:f73d42950021f9240389f99ddc5b0c7f1b533c054ba344654ff1edaf6bf827e3OperatorGroup が Operator とその依存関係をサポートする namespace

my-nsにあることを前提とし、イメージダイジェストを使用して CatalogSource オブジェクトを作成します。以下は例になります。apiVersion: operators.coreos.com/v1alpha1 kind: CatalogSource metadata: name: custom-redhat-operators namespace: my-ns spec: sourceType: grpc image: example_registry:5000/olm/redhat-operators@sha256:f73d42950021f9240389f99ddc5b0c7f1b533c054ba344654ff1edaf6bf827e3 displayName: Red Hat Operatorsカタログイメージから、利用可能な最新の

servicemeshoperatorおよびその依存関係を解決するサブスクリプションを作成します。apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: servicemeshoperator namespace: my-ns spec: source: custom-redhat-operators sourceNamespace: my-ns name: servicemeshoperator channel: "1.0"

第11章 CRD

11.1. カスタムリソース定義による Kubernetes API の拡張

以下では、カスタムリソース定義 (CRD) を作成し、管理することで、クラスター管理者が OpenShift Container Platform クラスターをどのように拡張できるかについて説明します。

11.1.1. カスタムリソース定義

Kubernetes API では、リソースは特定の種類の API オブジェクトのコレクションを保管するエンドポイントです。たとえば、ビルトインされた Pod リソースには Pod オブジェクトのコレクションが含まれます。

カスタムリソース定義 (CRD) オブジェクトは、クラスター内に新規の固有オブジェクト Kind を定義し、Kubernetes API サーバーにそのライフサイクル全体を処理させます。

カスタムリソース (CR) オブジェクトは、クラスター管理者によってクラスターに追加された CRD から作成され、すべてのクラスターユーザーが新規リソースタイプをプロジェクトに追加できるようにします。

クラスター管理者が新規 CRD をクラスターに追加する際に、Kubernetes API サーバーは、クラスター全体または単一プロジェクト (namespace) によってアクセスできる新規の RESTful リソースパスを作成することによって応答し、指定された CR を提供し始めます。

CRD へのアクセスを他のユーザーに付与する必要のあるクラスター管理者は、クラスターロールの集計を使用して admin、edit、または view のデフォルトクラスターロールを持つユーザーにアクセスを付与できます。また、クラスターロールの集計により、カスタムポリシールールをこれらのクラスターロールに挿入することができます。この動作は、新規リソースを組み込み型のインリソースであるかのようにクラスターの RBAC ポリシーに統合します。

Operator はとりわけ CRD を必要な RBAC ポリシーおよび他のソフトウェア固有のロジックでパッケージ化することで CRD を利用します。またクラスター管理者は、Operator のライフサイクル外にあるクラスターに CRD を手動で追加でき、これらをすべてのユーザーに利用可能にすることができます。

クラスター管理者のみが CRD を作成できる一方で、開発者は CRD への読み取りおよび書き込みパーミッションがある場合には、既存の CRD から CR を作成することができます。

11.1.2. カスタムリソース定義の作成

カスタムリソース (CR) オブジェクトを作成するには、クラスター管理者はまずカスタムリソース定義 (CRD) を作成する必要があります。

前提条件

-

cluster-adminユーザー権限を使用した OpenShift Container Platform クラスターへのアクセス

手順

CRD を作成するには、以下を実行します。

以下の例のようなフィールドタイプを含む YAML ファイルを作成します。

CRD の YAML ファイルサンプル

apiVersion: apiextensions.k8s.io/v1beta11 kind: CustomResourceDefinition metadata: name: crontabs.stable.example.com2 spec: group: stable.example.com3 version: v14 scope: Namespaced5 names: plural: crontabs6 singular: crontab7 kind: CronTab8 shortNames: - ct9 - 1

apiextensions.k8s.io/v1beta1API を使用します。- 2

- 定義の名前を指定します。これは

groupおよびpluralフィールドの値を使用する <plural-name>.<group> 形式である必要があります。 - 3

- API のグループ名を指定します。API グループは、論理的に関連付けられるオブジェクトのコレクションです。たとえば、

JobまたはScheduledJobなどのすべてのバッチオブジェクトはバッチ API グループ (batch.api.example.com など) である可能性があります。組織の完全修飾ドメイン名を使用することが奨励されます。 - 4

- URL で使用されるバージョン名を指定します。それぞれの API グループは複数バージョンで存在させることができます。たとえば、

v1alpha、v1beta、v1などが使用されます。 - 5

- カスタムオブジェクトがクラスター (

Cluster) の 1 つのプロジェクト (Namespaced) またはすべてのプロジェクトで利用可能であるかどうかを指定します。 - 6

- URL で使用される複数形の名前を指定します。

pluralフィールドは API URL のリソースと同じになります。 - 7

- CLI および表示用にエイリアスとして使用される単数形の名前を指定します。

- 8

- 作成できるオブジェクトの種類を指定します。タイプは CamelCase にすることができます。

- 9

- CLI でリソースに一致する短い文字列を指定します。

注記デフォルトで、CRD のスコープはクラスターで設定され、すべてのプロジェクトで利用可能です。

CRD オブジェクトを作成します。

$ oc create -f <file_name>.yaml新規の RESTful API エンドポイントは以下のように作成されます。

/apis/<spec:group>/<spec:version>/<scope>/*/<names-plural>/...たとえば、サンプルファイルを使用すると、以下のエンドポイントが作成されます。

/apis/stable.example.com/v1/namespaces/*/crontabs/...このエンドポイント URL を使用して CR を作成し、管理できます。オブジェクトの

Kindは、作成した CRD オブジェクトのspec.kindフィールドに基づいています。

11.1.3. カスタムリソース定義のクラスターロールの作成

クラスター管理者は、既存のクラスタースコープのカスタムリソース定義 (CRD) にパーミッションを付与できます。admin、edit、および view のデフォルトクラスターロールを使用する場合、これらのルールにクラスターロールの集計を利用します。

これらのロールのいずれかにパーミッションを付与する際は、明示的に付与する必要があります。より多くのパーミッションを持つロールはより少ないパーミッションを持つロールからルールを継承しません。ルールをあるロールに割り当てる場合、より多くのパーミッションを持つロールにもその動詞を割り当てる必要もあります。たとえば、get crontabs パーミッションを表示ロールに付与する場合、これを edit および admin ロールにも付与する必要があります。admin または edit ロールは通常、プロジェクトテンプレートでプロジェクトを作成したユーザーに割り当てられます。

前提条件

- CRD を作成します。

手順

CRD のクラスターロール定義ファイルを作成します。クラスターロール定義は、各クラスターロールに適用されるルールが含まれる YAML ファイルです。OpenShift Container Platform Controller はデフォルトクラスターロールに指定するルールを追加します。

カスタムロール定義の YAML ファイルサンプル

kind: ClusterRole apiVersion: rbac.authorization.k8s.io/v11 metadata: name: aggregate-cron-tabs-admin-edit2 labels: rbac.authorization.k8s.io/aggregate-to-admin: "true"3 rbac.authorization.k8s.io/aggregate-to-edit: "true"4 rules: - apiGroups: ["stable.example.com"]5 resources: ["crontabs"]6 verbs: ["get", "list", "watch", "create", "update", "patch", "delete", "deletecollection"]7 --- kind: ClusterRole apiVersion: rbac.authorization.k8s.io/v1 metadata: name: aggregate-cron-tabs-view8 labels: # Add these permissions to the "view" default role. rbac.authorization.k8s.io/aggregate-to-view: "true"9 rbac.authorization.k8s.io/aggregate-to-cluster-reader: "true"10 rules: - apiGroups: ["stable.example.com"]11 resources: ["crontabs"]12 verbs: ["get", "list", "watch"]13 - 1

rbac.authorization.k8s.io/v1API を使用します。- 2 8

- 定義の名前を指定します。

- 3

- パーミッションを管理のデフォルトロールに付与するためにこのラベルを指定します。

- 4

- パーミッションを編集のデフォルトロールに付与するためにこのラベルを指定します。

- 5 11

- CRD のグループ名を指定します

- 6 12

- これらのルールが適用される CRD の複数形の名前を指定します。

- 7 13

- ロールに付与されるパーミッションを表す動詞を指定します。たとえば、読み取りおよび書き込みパーミッションを

adminおよびeditロールに適用し、読み取り専用パーミッションをviewロールに適用します。 - 9

- このラベルを指定して、パーミッションを

viewデフォルトロールに付与します。 - 10

- このラベルを指定して、パーミッションを

cluster-readerデフォルトロールに付与します。

クラスターロールを作成します。

$ oc create -f <file_name>.yaml

11.1.4. ファイルからのカスタムリソースの作成

カスタムリソース定義 (CRD) がクラスターに追加された後に、クラスターリソース (CR) は CR 仕様を使用するファイルを使って CLI で作成できます。

前提条件

- CRD がクラスター管理者によってクラスターに追加されている。

手順

CR の YAML ファイルを作成します。以下の定義例では、

cronSpecとimageのカスタムフィールドがKind: CronTabのCR に設定されます。このKindは、CRD オブジェクトのspec.kindフィールドから取得します。CR の YAML ファイルサンプル

apiVersion: "stable.example.com/v1"1 kind: CronTab2 metadata: name: my-new-cron-object3 finalizers:4 - finalizer.stable.example.com spec:5 cronSpec: "* * * * /5" image: my-awesome-cron-imageファイルの作成後に、オブジェクトを作成します。

$ oc create -f <file_name>.yaml

11.1.5. カスタムリソースの検査

CLI を使用してクラスターに存在するカスタムリソース (CR) オブジェクトを検査できます。

前提条件

- CR オブジェクトがアクセスできる namespace にあること。

手順

CR の特定の

Kindについての情報を取得するには、以下を実行します。$ oc get <kind>以下は例になります。

$ oc get crontab NAME KIND my-new-cron-object CronTab.v1.stable.example.comリソース名では大文字と小文字が区別されず、CRD で定義される単数形または複数形のいずれか、および任意の短縮名を指定できます。以下は例になります。

$ oc get crontabs $ oc get crontab $ oc get ctCR の未加工の YAML データを確認することもできます。

$ oc get <kind> -o yaml$ oc get ct -o yaml apiVersion: v1 items: - apiVersion: stable.example.com/v1 kind: CronTab metadata: clusterName: "" creationTimestamp: 2017-05-31T12:56:35Z deletionGracePeriodSeconds: null deletionTimestamp: null name: my-new-cron-object namespace: default resourceVersion: "285" selfLink: /apis/stable.example.com/v1/namespaces/default/crontabs/my-new-cron-object uid: 9423255b-4600-11e7-af6a-28d2447dc82b spec: cronSpec: '* * * * /5'1 image: my-awesome-cron-image2

11.2. カスタムリソース定義からのリソースの管理

以下では、開発者がカスタムリソース定義 (CRD) にあるカスタムリソース (CR) をどのように管理できるかについて説明します。

11.2.1. カスタムリソース定義

Kubernetes API では、リソースは特定の種類の API オブジェクトのコレクションを保管するエンドポイントです。たとえば、ビルトインされた Pod リソースには Pod オブジェクトのコレクションが含まれます。

カスタムリソース定義 (CRD) オブジェクトは、クラスター内に新規の固有オブジェクト Kind を定義し、Kubernetes API サーバーにそのライフサイクル全体を処理させます。

カスタムリソース (CR) オブジェクトは、クラスター管理者によってクラスターに追加された CRD から作成され、すべてのクラスターユーザーが新規リソースタイプをプロジェクトに追加できるようにします。

Operator はとりわけ CRD を必要な RBAC ポリシーおよび他のソフトウェア固有のロジックでパッケージ化することで CRD を利用します。またクラスター管理者は、Operator のライフサイクル外にあるクラスターに CRD を手動で追加でき、これらをすべてのユーザーに利用可能にすることができます。

クラスター管理者のみが CRD を作成できる一方で、開発者は CRD への読み取りおよび書き込みパーミッションがある場合には、既存の CRD から CR を作成することができます。

11.2.2. ファイルからのカスタムリソースの作成

カスタムリソース定義 (CRD) がクラスターに追加された後に、クラスターリソース (CR) は CR 仕様を使用するファイルを使って CLI で作成できます。

前提条件

- CRD がクラスター管理者によってクラスターに追加されている。

手順

CR の YAML ファイルを作成します。以下の定義例では、

cronSpecとimageのカスタムフィールドがKind: CronTabのCR に設定されます。このKindは、CRD オブジェクトのspec.kindフィールドから取得します。CR の YAML ファイルサンプル

apiVersion: "stable.example.com/v1"1 kind: CronTab2 metadata: name: my-new-cron-object3 finalizers:4 - finalizer.stable.example.com spec:5 cronSpec: "* * * * /5" image: my-awesome-cron-imageファイルの作成後に、オブジェクトを作成します。

$ oc create -f <file_name>.yaml

11.2.3. カスタムリソースの検査

CLI を使用してクラスターに存在するカスタムリソース (CR) オブジェクトを検査できます。

前提条件

- CR オブジェクトがアクセスできる namespace にあること。

手順

CR の特定の

Kindについての情報を取得するには、以下を実行します。$ oc get <kind>以下は例になります。

$ oc get crontab NAME KIND my-new-cron-object CronTab.v1.stable.example.comリソース名では大文字と小文字が区別されず、CRD で定義される単数形または複数形のいずれか、および任意の短縮名を指定できます。以下は例になります。

$ oc get crontabs $ oc get crontab $ oc get ctCR の未加工の YAML データを確認することもできます。

$ oc get <kind> -o yaml$ oc get ct -o yaml apiVersion: v1 items: - apiVersion: stable.example.com/v1 kind: CronTab metadata: clusterName: "" creationTimestamp: 2017-05-31T12:56:35Z deletionGracePeriodSeconds: null deletionTimestamp: null name: my-new-cron-object namespace: default resourceVersion: "285" selfLink: /apis/stable.example.com/v1/namespaces/default/crontabs/my-new-cron-object uid: 9423255b-4600-11e7-af6a-28d2447dc82b spec: cronSpec: '* * * * /5'1 image: my-awesome-cron-image2

第12章 Operator SDK

12.1. Operator SDK の使用を開始する

以下では、Operator SDK の基本事項についての概要を説明し、単純な Go ベースの Memcached Operator のビルドおよびインストールからアップグレードまでのそのライフサイクル管理の例を使って、(OpenShift Container Platform などの) クラスター管理者の Kubernetes ベースのクラスターへのアクセスを持つ Operator の作成者を支援します。

これは、Operator SDK (operator-sdk CLI ツールおよび controller-runtime ライブラリー API) と Operator Lifecycle Manager (OLM) という 2 つの Operator Framework の重要な構成要素を使用して実行されます。

OpenShift Container Platform 4.3 は Operator SDK v0.12.0 以降をサポートします。

12.1.1. Operator SDK のアーキテクチャー

Operator Framework は Operator という Kubernetes ネイティブアプリケーションを効果的かつ自動化された拡張性のある方法で管理するためのオープンソースツールキットです。Operator は、プロビジョニング、スケーリング、バックアップおよび復元などのクラウドサービスの自動化の利点を提供し、同時に Kubernetes が実行されるいずれの場所でも実行できます。

Operator により、Kubernetes の上部に複雑で、ステートフルなアプリケーションを管理することが容易になります。ただし、現時点で Operator の作成は、低レベルの API の使用、スケルトンコードの作成、モジュール化の欠如による重複の発生などの課題があるために困難になる場合があります。

Operator SDK は、以下を提供して Operator をより容易に作成できるように設計されたフレームワークです。

- 運用ロジックをより直感的に作成するための高レベルの API および抽象化

- 新規プロジェクトを迅速にブートストラップするためのスケルトンコードの作成およびコード生成ツール

- 共通する Operator ユースケースに対応する拡張機能

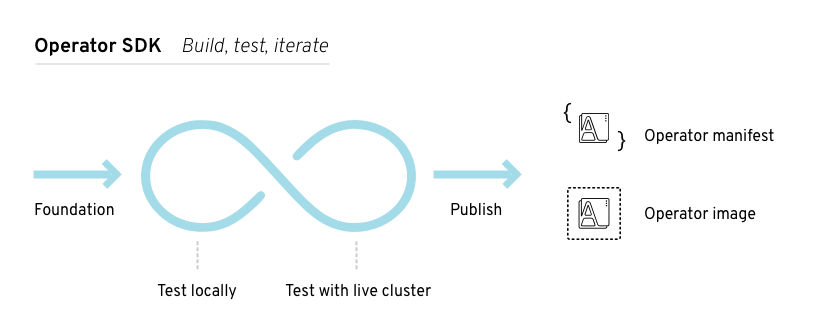

12.1.1.1. ワークフロー

Operator SDK は、新規 Operator を開発するために以下のワークフローを提供します。

- Operator SDK コマンドラインインターフェース (CLI) を使用した新規 Operator プロジェクトの作成。

- カスタムリソース定義 (CRD) を追加することによる新規リソース API の定義。

- Operator SDK API を使用した監視対象リソースの指定。

- 指定されたハンドラーでの Operator 調整 (reconciliation) ロジックの定義、およびリソースと対話するための Operator SDK API の使用。

- Operator Deployment マニフェストをビルドし、生成するための Operator SDK CLI の使用。

図12.1 Operator SDK ワークフロー

高次元では、Operator SDK を使用する Operator は Operator の作成者が定義するハンドラーで監視対象のリソースについてのイベントを処理し、アプリケーションの状態を調整するための動作を実行します。

12.1.1.2. マネージャーファイル

Operator の主なプログラムは、cmd/manager/main.go のマネージャーファイルです。マネージャーは、pkg/apis/ で定義されるすべてのカスタムリソース(CR) のスキームを自動的に登録し、pkg/controller/ 下のすべてのコントローラーを実行します。

マネージャーは、すべてのコントローラーがリソースの監視に使用する namespace を制限できます。

mgr, err := manager.New(cfg, manager.Options{Namespace: namespace})デフォルトでは、これは Operator が実行されている namespace です。すべての namespace を確認するには、namespace オプションのオプションを空のままにすることができます。

mgr, err := manager.New(cfg, manager.Options{Namespace: ""})12.1.1.3. Prometheus Operator

Prometheus はオープンソースのシステムモニタリングおよびアラートツールキットです。Prometheus Operator は、 OpenShift Container Platform などの Kubernetes ベースのクラスターで実行される Prometheus クラスターを作成し、設定し、管理します。

ヘルパー関数は、デフォルトで Operator SDK に存在し、Prometheus Operator がデプロイされているクラスターで使用できるように生成された Go ベースの Operator にメトリクスを自動的にセットアップします。

12.1.2. Operator SDK CLI のインストール

Operator SDK には、開発者による新規 Operator プロジェクトの作成、ビルドおよびデプロイを支援をする CLI ツールが含まれます。ワークステーションに SDK CLI をインストールして、独自の Operator のオーサリングを開始することができます。

12.1.2.1. GitHub リリースからのインストール

GitHub のプロジェクトから SDK CLI の事前ビルドリリースのバイナリーをダウンロードし、インストールできます。