Cluster Suite 개요

Red Hat Enterprise Linux 5 용 Red Hat Cluster Suite

엮음 3

초록

소개

- Red Hat Enterprise Linux 설치 가이드 — Red Hat Enterprise Linux 5 설치 관련 내용을 다루고 있습니다.

- Red Hat Enterprise Linux 활용 가이드 — Red Hat Enterprise Linux 5 설정, 활용, 관리 관련 내용을 다루고 있습니다.

- Red Hat Cluster 설정 및 관리 — Red Hat Cluster 설치, 설정, 관리에 관한 내용을 다루고 있습니다.

- Logical Volume Manager Administration — Provides a description of the Logical Volume Manager (LVM), including information on running LVM in a clustered environment.

- Global File System: 설정 및 관리 — Red Hat GFS (Red Hat Global File System) 설치, 설정, 관리에 관한 내용을 다루고 있습니다.

- Global File System 2: 설정 및 관리 — Red Hat GFS2 (Red Hat Global File System 2) 설치, 설정, 관리에 관한 내용을 다루고 있습니다.

- Device-Mapper Multipath 사용 — Red Hat Enterprise Linux 5의 Device-Mapper Multipath 기능 사용에 관한 내용을 다루고 있습니다.

- Global File System을 통한 GNBD 사용 — Red Hat GFS를 통한 GNBD(Global Network Block Device) 사용에 관한 개요를 다루고 있습니다.

- Linux 가상 서버 관리 — LVS (Linux Virtual Server)를 통한 고성능 시스템 및 서비스 설정에 관한 내용을 다루고 있습니다.

- Red Hat Cluster Suite 릴리즈 노트 — Red Hat Cluster Suite 최신 릴리즈에 관한 내용을 다루고 있습니다.

1. 피드백

Cluster_Suite_Overview(EN)-5 (2009-08-18T15:49)

Cluster_Suite_Overview(EN)-5 (2009-08-18T15:49)

1장. Red Hat Cluster Suite 개요

1.1. 클러스터 기초

- 스토리지 (Storage)

- 고가용성 (High availability)

- 로드 밸런싱 (Load balancing)

- 고성능 (High performance)

참고

1.2. Red Hat Cluster Suite Introduction

- 클러스터 인프라 — 클러스터로 함께 동작하기 위해 노드에 기본적인 기능을 제공합니다. 이에는 설정-파일 관리, 멤버쉽 관리, 잠금 관리, fencing과 같은 기능이 있습니다.

- 고가용성 서비스 관리 — 노드가 작동하지 않을 경우 하나의 클러스터 노드에서 다른 노드로 장애조치 서비스를 제공합니다.

- 클러스터 관리 도구 — Red Hat 클러스터 셋업, 설정, 관리에 필요한 설정 및 관리 도구입니다. 클러스터 인프라 구성 요소, 고가용성, 서비스 관리 구성요소, 스토리지와 함께 사용되는 도구입니다.

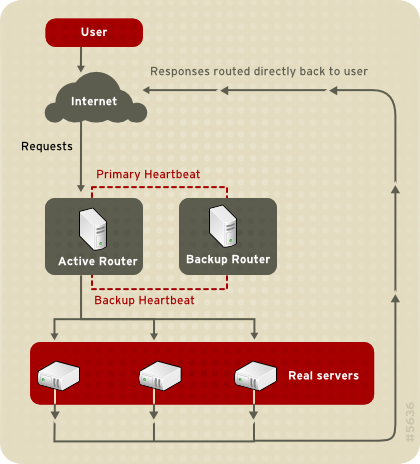

- LVS (Linux Virtual Server) — IP 로드 밸런싱을 제공하는 라우팅 소프트웨어입니다. LVS 서버 뒤에 있는 실제 서버로 클라이언트 요청을 균등하게 보내는 중복서버 쌍에서 LVS가 실행됩니다.

- Red Hat GFS (Global File System) — Red Hat Cluster Suite과 함께 사용할 클러스터 파일 시스템을 제공합니다. 스토리지가 각각의 클러스터 노드에 로컬로 연결되어 있는 것처럼 GFS는 다중 노드가 블록 레벨에서 스토리지를 공유하게 합니다.

- CLVM (Cluster Logical Volume Manager) — 클러스터 스토리지의 볼륨을 관리합니다.

참고

When you create or modify a CLVM volume for a clustered environment, you must ensure that you are running theclvmddaemon. For further information, refer to 1.6절. “CLVM (Cluster Logical Volume Manager)”. - GNBD (Global Network Block Device) — GFS의 보조 구성 요소로 이더넷에 블록 레벨 스토리지를 내보냅니다. 이는 블록 레벨 스토리지를 Red Hat GFS에서 사용 가능하게 하기 위한 경제적인 방법입니다.

그림 1.1. Red Hat Cluster Suite Introduction

참고

1.3. Cluster Infrastructure

- 클러스터 관리

- 잠금 관리

- Fencing

- 클러스터 설정 관리

1.3.1. 클러스터 관리

참고

그림 1.2. CMAN/DLM Overview

1.3.2. 잠금 관리

1.3.3. Fencing

fenced.

fenced는 장애 발생 노드를 차단합니다. 다른 클러스터 인프라 구성 요소는 어떤 작업을 취할 지를 결정합니다 — 즉, 노드에 필요한 복구 작업을 실행합니다. 예를 들어, 노드 장애 발생시 fenced가 장애가 발생한 노드에 fencing 작업을 완료할 때까지 DLM 및 GFS는 작업을 일시 중지합니다. 장애 발생한 노드의 fencing 작업이 완료되면, DLM 및 GFS는 복구 작업을 실행합니다. DLM은 장애 발생 노드의 잠금 기능을 해재하고, GFS는 장애 발생 노드의 저널을 복구합니다.

- Power fencing — 실행 불가능한 노드의 전원을 끄기위해 전원 제어기를 사용하는 fencing 방법

- Fibre Channel switch fencing — 스토리지를 실행 불가능한 노드로 연결시키는 Fibre Channel 포트를 비활성화시키는 fencing 방법

- GNBD fencing — A fencing method that disables an inoperable node's access to a GNBD server.

- 기타 fencing 방법 — IBM Bladecenters, PAP, DRAC/MC, HP ILO, IPMI, IBM RSA II, 기타 등등을 포함하여 실행 불가능한 노드의 I/O 또는 전원을 비활성화시키는 기타 다른 fencing 방법

그림 1.3. Power Fencing Example

그림 1.4. Fibre Channel Switch Fencing Example

그림 1.5. Fencing a Node with Dual Power Supplies

그림 1.6. Fencing a Node with Dual Fibre Channel Connections

1.3.4. 클러스터 설정 시스템

그림 1.7. CCS Overview

그림 1.8. Accessing Configuration Information

/etc/cluster/cluster.conf)은 XML 파일로 다음과 같은 클러스터 특징이 설명되어 있습니다:

- 클러스터 이름 — 클러스터 이름, 클러스터 설정 파일 개정 레벨, 노드가 클러스터에 결합할 때에나 클러스터에서 fence될 때 사용되는 기본적인 fence 타이밍 등록 정보를 보여 줍니다.

- 클러스터 — 클러스터의 각 노드, 설정된 노드 이름, 노드 ID, 정족수 투표수, 노드의 fencing 방법을 보여줍니다.

- Fence 장치 — 클러스터에 있는 fence 장치를 보여줍니다. 매개 변수는 fence 장치의 유형에 따라 다양합니다. 예를 들어 fence 장치로 전원 제어기가 사용될 경우, 클러스터 설정에서는 전원 제어기의 이름, 제어기의 IP 주소, 로그인, 암호를 지정합니다.

- 관리 리소스 — 클러스터 서비스를 생성하는데 필요한 리소스를 보여줍니다. 관리 리소스에는 장애 조치 도메인에 대한 정의, 리소스 (예: IP 주소), 서비스가 포함됩니다. 관리 리소스에서는 클러스터 서비스와 클러스터 서비스의 장애 조치 기능 모두를 지정합니다.

1.4. 고가용성 서비스 관리

rgmanager는 상용 어플리케이션에 필요한 cold failover를 실행합니다. Red Hat 클러스터에서 어플리케이션은 고가용성 클러스터 서비스를 구축하기 위해 다른 클러스터 리소스로 설정되어 있습니다. 고가용성 클러스터 서비스는 클러스터 클라이언트에 장애를 일으키지 않고 하나의 클러스터 노드에서 다른 노드로 장애 조치될 수 있습니다. 클러스터 노드에 문제가 발생한 경우나 또는 클러스터 시스템 관리자가 다른 클러스터 노드로 서비스를 이전할 경우 클러스터 서비스 장애 조치가 실행될 수 있습니다. (예: 클러스터 노드의 정기적 중지와 같은 경우)

참고

그림 1.9. 장애조치 도메인

- IP 주소 리소스 — IP 주소 10.10.10.201.

- An application resource named "httpd-content" — a web server application init script

/etc/init.d/httpd(specifyinghttpd). - A file system resource — Red Hat GFS named "gfs-content-webserver".

그림 1.10. Web Server Cluster Service Example

1.5. Red Hat GFS

- 데이터 기반 구조의 단순화

- 모든 클러스터에 대해 한 번만 어플리케이션을 설치 및 패치

- 어플리케이션 데이터의 여유 사본 (복사본)의 필요성 배제

- 여러 클라이언트가 동시에 데이터로 읽기/쓰기 작업 액세스 가능

- 백업 및 장애 복구의 단순화 (하나의 파일 시스템에만 백업 또는 복구)

- 스토리지 리소스 사용을 극대화; 스토리지 관리 비용을 최소화

- 파티션 대신 전체적으로 스토리지 관리

- 데이타 중복을 감소시켜 전체 스토리지의 니즈를 최소화

- 클러스터를 동일하게 확장시키고 스토리지나 서버를 즉시 추가

- 복잡한 테크닉없이 스토리지 파티션하기

- 동일 파일 시스템에 서버를 마운팅하여 간편하게 서버 추가

참고

1.5.1. 우수한 성능 및 확장성

그림 1.11. GFS with a SAN

1.5.2. 성능, 확장성, 적절한 가격

그림 1.12. GFS and GNBD with a SAN

1.5.3. 경제성 및 성능

그림 1.13. 직접 연결된 스토리지를 사용하는 GFS 및 GNBD

1.6. CLVM (Cluster Logical Volume Manager)

clvmd. clvmd is a daemon that provides clustering extensions to the standard LVM2 tool set and allows LVM2 commands to manage shared storage. clvmd runs in each cluster node and distributes LVM metadata updates in a cluster, thereby presenting each cluster node with the same view of the logical volumes (refer to 그림 1.14. “CLVM Overview”). Logical volumes created with CLVM on shared storage are visible to all nodes that have access to the shared storage. CLVM allows a user to configure logical volumes on shared storage by locking access to physical storage while a logical volume is being configured. CLVM uses the lock-management service provided by the cluster infrastructure (refer to 1.3절. “Cluster Infrastructure”).

참고

clvmd)이나 HA-LVM (High Availability Logical Volume Management) 에이전트를 실행하고 있어야 합니다. clvmd 데몬이나 HA-LVM을 실행상의 이유나 해당 인타이틀먼트를 갖고 있지 않아 사용할 수 없을 경우, 데이터 손실을 가져올 수 있으므로 공유 디스크상에서 단일 인스턴스 LVM을 사용해서는 안됩니다. 다른 문제가 있을 경우 Red Hat 서비스 담당자에게 연락하시기 바랍니다.

참고

/etc/lvm/lvm.conf에 클러스터 전반에 걸친 잠금 기능에 필요한 사항을 변경해야 합니다.

그림 1.14. CLVM Overview

그림 1.15. LVM Graphical User Interface

그림 1.16. Conga LVM Graphical User Interface

그림 1.17. Creating Logical Volumes

1.7. GNBD (Global Network Block Device)

그림 1.18. GNBD 개요

1.8. LVS (Linux Virtual Server)

- 실제 서버를 통한 로드 밸런스

- 각각의 실제 서버에서의 서비스 무결성 확인

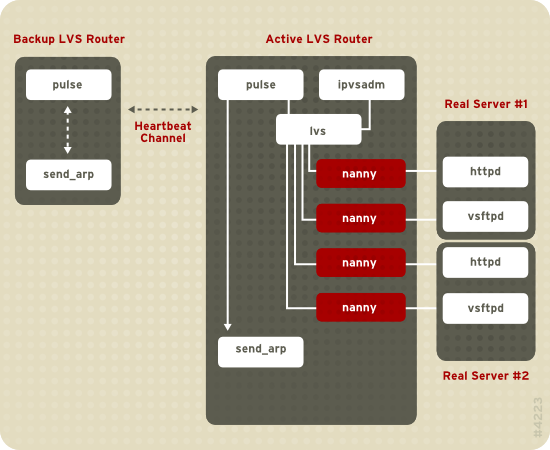

그림 1.19. Components of a Running LVS Cluster

pulse 데몬은 활성 및 비활성 LVS 라우터에서 실행됩니다. 백업 LVS 라우터에서 pulse는 활성 라우터의 공개 인터페이스로 heartbeat를 보내어 활성 LVS 라우터가 올바르게 작동하는 지를 확인합니다. 활성 LVS 라우터에서 pulse는 lvs 데몬을 시작하고 백업 LVS 라우터에서의 heartbeat 쿼리에 응답합니다.

lvs 데몬이 시작되면 이는 ipvsadm 유틸리티를 호출하여 커널에 있는 IPVS (IP Virtual Server) 라우팅 테이블을 설정 및 관리하고 각각의 실제 서버에 있는 설정된 가상 서버에 필요한 nanny 프로세스를 시작합니다. 각각의 nanny 프로세스는 하나의 실제 서버에서 설정된 서비스의 상태를 확인하고 실제 서버에 있는 서비스가 잘 작동하지 않을 경우 lvs 데몬에 보고합니다. 작동 불량 사항이 발견되면, lvs 데몬은 ipvsadm에 지시하여 IPVS 라우팅 테이블에서 실제 서버를 삭제합니다.

send_arp를 호출하여 장애조치를 시작하고, 활성 LVS 라우터에 있는 lvs 데몬을 종료하기 위해 공개 및 개인 네트워크 인터페이스를 통해 활성 LVS 라우터에 명령을 보낸 후, 설정된 가상 서버의 요청을 수락하기 위해 백업 LVS 라우터에 있는 lvs 데몬을 시작합니다.

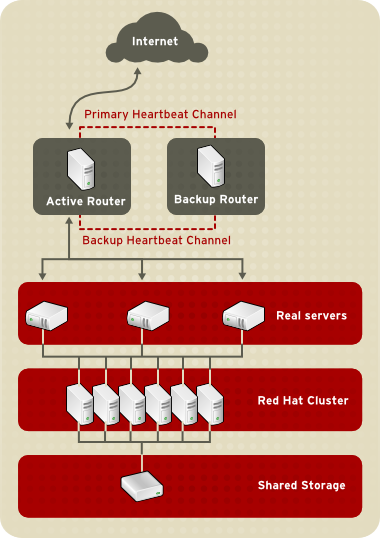

- 실제 서버를 통한 데이터 동기화

- 공유된 데이터 액세스에 필요한 토폴로지에 세번째 레이어 추가

rsync와 같은 프로그램을 사용하여 일정 간격으로 모든 노드에 걸쳐 변경된 데이터를 복사할 수 있습니다. 하지만, 사용자가 수시로 파일을 업로드하거나 데이터베이스를 처리해야 하는 상황에서 데이터 동기화를 위해 스크립트를 사용하거나 또는 rsync을 사용하는 것은 동기화 기능을 최적화하지 못합니다. 따라서, 과중한 업로드, 데이터 베이스 처리량, 소통량이 있는 실제 서버에서는 데이터 동기화를 위해 3-tier 토폴로지를 사용하는 것이 좋습니다.

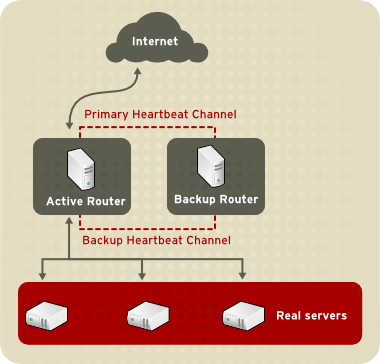

1.8.1. Two-Tier LVS Topology

그림 1.20. Two-Tier LVS Topology

eth0:1로 알리아스될 수 있습니다. 다른 방법으로 각각의 가상 서버는 서비스마다 분리된 장치와 연관시킬 수 있습니다. 예를 들어, HTTP 소통량은 eth0:1에서 처리될 수 있으며, FTP 소통량은 eth0:2에서 처리될 수 있습니다.

- 라운드 로빈 (Round-Robin) 스케줄링 — 각각의 요청을 실제 서버의 풀로 순차적으로 배분하는 방식입니다. 이러한 알고리즘을 사용하여 용량이나 부하량을 고려하지 않고 모든 실제 서버를 동일하게 다룹니다.

- 가중치 기반 라운드 로빈 (Round-Robin) 스케줄링 — 각각의 요청을 실제 서버의 풀로 순차적으로 배분하는 방식이지만 거대한 처리 용량으로 서버에 더 많은 작업을 배분합니다. 처리 용량은 사용자 지정 가중치 요인에 의해 나타나며 동적 부하 정보에 의해 상하로 조정됩니다. 이는 서버 풀에 있는 실제 서버의 용량이 다를 경우 선택할 수 있는 사항입니다. 하지만, 요청 부하량이 아주 다양할 경우, 더 가중치가 있는 서버가 서버의 공유 또는 요청량보다 더 많이 응답할 수 있습니다.

- 최소 접속 (Least-Connection) 스케줄링 — 가장 접속이 적은 실제 서버로 더 많은 요청을 배분하는 방식입니다. 이는 동적인 스케줄링 알고리즘 유형 중 하나로, 요청 부하에 극도로 다양한 처리량이 있을 경우 유용합니다. 각각의 서버 노드에 대략 비슷한 처리 용량이 있는 실제 서버 풀의 경우에도 적합합니다. 실제 서버가 다양한 처리 용량이 있고, 가중치 기반 최소 접속 스케줄링일 경우 아주 적합합니다.

- 가중치 기반 최소 접속 (Weighted Least-Connections) 스케줄링 (기본값) — 처리 용량과 관련하여 가장 접속이 적은 서버로 더 많은 요청을 배분하는 방식입니다. 처리 용량은 사용자 지정 가중치 요인에 의해 나타나며, 동적 부하 정보에 의해 상하로 조정됩니다. 실제 서버 풀에 다양한 처리 용량의 하드웨어가 있을 경우 이러한 알로리즘이 적합합니다.

- LBLC (Locality-Based Least-Connection) 스케줄링 — 목적지 IP와 관련하여 가장 접속이 적은 서버로 더 많은 요청을 배분하는 방식입니다. 이러한 알고리즘은 프록시-캐쉬 서버 클러스터에서 사용됩니다. 이는 서버가 서버 처리 용량을 초과하지 않고 반부하에 서버가 있지 않을 경우 IP 주소를 최소로 부하되는 실제 서버로 할당하게 되어 IP 주소에 대한 패킷을 해당 주소에 대한 서버로 라우팅합니다.

- LBLCR (Locality-Based Least-Connection with Replication) 스케줄링 — 목적지 IP와 관련하여 가장 접속이 적은 서버로 더 많은 요청을 배분하는 방식입니다. 이러한 알고리즘은 프록시-캐쉬 서버 클러스터에 사용됩니다. 대상 IP 주소를 실제 서버 노드의 서브셋으로 묶는 다는 점에서 LBLC 스케줄링과 다릅니다. 이는 서브셋에 있는 가장 접속이 적은 서버로 요청을 라우트합니다. 목적지 IP 주소에 대해 모든 노드가 처리 용량을 초과할 경우, 가장 접속이 적은 실제 서버를 실제 서버의 전체 풀에서 목적지 IP의 실제 서버에 대한 서브셋으로 추가하여 해당 목적지 IP 주소에 대한 새로운 서버를 복사합니다. 최고로 과부화된 노드는 실제 서버 서브셋에서 빠지게 됩니다.

- 소스 해쉬 (Source Hash) 스케줄링 — 정적 해쉬 테이블에 있는 소스 IP를 찾아 실제 서버의 풀로 요청을 배분하는 방식입니다. 이러한 알고리즘은 여러 방화벽이 있는 LVS 라우터에 사용됩니다.

1.8.2. Three-Tier LVS Topology

그림 1.21. Three-Tier LVS Topology

1.8.3. 라우팅 방식

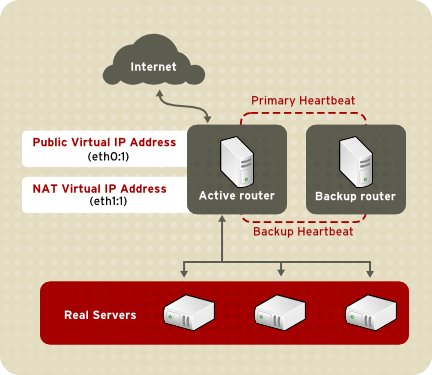

1.8.3.1. NAT 라우팅

그림 1.22. LVS Implemented with NAT Routing

1.8.3.2. 직접 라우팅

그림 1.23. LVS Implemented with Direct Routing

arptables 패킷 필터링 도구를 사용하여 실행합니다.

1.8.4. 지속성 및 방화벽 표시 기능

1.8.4.1. Persistence

1.8.4.2. 방화벽 표시 기능

1.9. 클러스터 관리 도구

1.9.1. Conga

- 클러스터 및 스토리지 관리에 필요한 하나의 웹 인터페이스

- 클러스터 데이터의 자동 디플로이 및 패키지 지원

- 기존 클러스터와 쉽게 통합

- 재인증할 필요가 없음

- 클러스터 상태 및 로그의 통합

- 사용자 권한을 통한 정교한 제어 기능

- — 컴퓨터 추가 또는 삭제, 사용자 추가 또는 삭제, 사용자 권한 설정을 위한 도구를 제공합니다. 시스템 관리자만이 이 탭에 액세스할 수 있습니다.

- — 클러스터 생성 및 관리를 위한 도구를 제공합니다. luci의 각각의 인스턴스는 luci를 사용하여 설정된 클러스터를 나열합니다. 시스템 관리자는 이 탭에 나열된 모든 클러스터를 관리할 수 있습니다. 기타 다른 사용자는 관리 권한이 있는 클러스터만 관리할 수 있습니다. (관리자에 의해 권한을 받음).

- — 스토리지의 원격 관리를 위한 도구를 제공합니다. 이 탭에 있는 도구를 사용하여 스토리지의 클러스터 소속 여부에 상관 없이 컴퓨터 상에 있는 스토리지를 관리할 수 있습니다.

그림 1.24. luci 탭

그림 1.25. luci 탭

그림 1.26. luci 탭

1.9.2. 클러스터 관리 GUI

system-config-cluster cluster administration graphical user interface (GUI) available with Red Hat Cluster Suite. The GUI is for use with the cluster infrastructure and the high-availability service management components (refer to 1.3절. “Cluster Infrastructure” and 1.4절. “고가용성 서비스 관리 ”). The GUI consists of two major functions: the Cluster Configuration Tool and the Cluster Status Tool. The Cluster Configuration Tool provides the capability to create, edit, and propagate the cluster configuration file (/etc/cluster/cluster.conf). The Cluster Status Tool provides the capability to manage high-availability services. The following sections summarize those functions.

1.9.2.1. Cluster Configuration Tool

그림 1.27. Cluster Configuration Tool

/etc/cluster/cluster.conf)에 있는 클러스터 설정 구성 요소를 보여줍니다. 구성 요소 이름의 왼쪽에 있는 삼각 아이콘은 하나 이상의 부수적 요소가 있는 구성 요소를 나타냅니다. 삼각 아이콘을 클릭하여 각 구성요소 아래의 세가지 부분을 펼쳐 볼 수 있습니다. 다음에서는 GUI에 있는 구성요소에 관한 요약을 다루고 있습니다:

- Cluster Nodes — 클러스터 노드를 보여 줍니다. 노드는 Cluster Nodes에서 부속 요소로 노드 이름으로 나타납니다. 오른쪽 하단 프레임 (Properties아래)에 있는 설정 버튼을 사용하여 노드를 추가, 삭제할 수 있으며 노드 등록 정보를 편집하고 각 노드의 fencing 방법을 설정할 수 있습니다.

- Fence Devices — fence 장치를 보여줍니다. fence 장치는 Fence Devices에서 부속 요소로 나타납니다. 오른쪽 하단 프레임 (Properties 아래)에 있는 설정 버튼을 사용하여 fence 장치를 추가, 삭제할 수 있으며 fence 장치 등록정보를 편집할 수 있습니다. Fence 장치는 각각의 노드에 필요한 fencing을 ( 버튼을 사용) 설정하기 전에 지정해야 합니다.

- Managed Resources — 장애 조치 도메인, 리소스, 서비스를 보여줍니다.

- Failover Domains — 노드에 장애 발생 시 고가용성 서비스 실행에 사용할 한 개 이상의 클러스토 노드 서브셋을 설정합니다. 장애 조치 도메인은 Failover Domains 아래에서 부수적인 요소로서 나타납니다. 오른쪽 하단 프레임 (Properties아래)에 있는 설정 버튼을 사용하여 (Failover Domains가 선택되었을 경우) 장애 조치 도메인을 생성하거나 또는 (failover domain이 선택되었을 경우) 장애 조치 도메인 등록 정보를 편집할 수 있습니다.

- Resources — 고가용성 서비스로 사용할 공유 리소스를 설정합니다. 공유 리소스에는 파일 시스템, IP 주소, NFS 마운트 및 내보내기, 클러스터에 있는 모든 고가용성 서비스에서 사용 가능한 사용자 생성 스크립트가 들어 있습니다. 리소스는 Resources 하에서 부수적인 요소로 나타납니다. 오른쪽 하단 프레임 (Properties 아래)에 있는 설정 버튼을 사용하여 Resources가 선택되었을 경우) 리소스를 생성하거나 또는 (resource가 선택되었을 경우) 리소스 등록 정보를 편집할 수 있습니다.

참고

Cluster Configuration Tool로 개인 리소스를 설정할 수 있습니다. 개인 리소스는 하나의 서버에서만 사용하도록 설정된 리소스입니다. GUI에 있는 Service 구성 요소에서 개인 리소스를 설정할 수 있습니다. - Services — 고가용성 서비스를 생성하고 설정합니다. (공유 또는 개인) 리소스와 장애 조치 도메인을 할당하고 서비스에 필요한 복구 정책을 정의하는 것으로 서비스는 설정됩니다. 서비스는 Services 하의 부수적인 요소로 나타납니다. 오른쪽 하단 프레임 (Properties 아래)에 있는 설정 버튼을 사용하여 (Services가 선택되었을 경우)서비스를 생성하거나 또는 (service가 선택되었을 경우) 서비스 등록 정보를 편집할 수 있습니다.

1.9.2.2. Cluster Status Tool

그림 1.28. Cluster Status Tool

/etc/cluster/cluster.conf)에 의해 결정됩니다. Cluster Status Tool를 사용하여 고가용성 서비스를 활성화, 비활성화, 재시작, 재배치할 수 있습니다.

1.9.3. 명령행 관리 도구

system-config-cluster Cluster Administration GUI, command line tools are available for administering the cluster infrastructure and the high-availability service management components. The command line tools are used by the Cluster Administration GUI and init scripts supplied by Red Hat. 표 1.1. “명령행 도구 ” summarizes the command line tools.

| 명령행 도구 | 용도 | 목적 |

|---|---|---|

ccs_tool — 클러스터 설정 시스템 도구 | Cluster Infrastructure | ccs_tool은 클러스터 설정 파일에 온라인 업데이트를 하기 위한 프로그램입니다. 이는 클러스터 인프라 구성요소를 생성하고 편집하는 기능을 제공합니다. (예: 클러스터 생성, 노드 추가 및 삭제) 이러한 도구에 관한 자세한 내용은 ccs_tool(8) 맨 페이지를 참조하시기 바랍니다. |

cman_tool — 클러스터 관리 도구 | Cluster Infrastructure | cman_tool은 CMAN 클러스터 관리자를 관리하기 위한 프로그램입니다. 이는 클러스터 연결, 클러스터 분리, 노드 삭제, 클러스터에 있는 노드의 예상 정족수 투표를 변경하는 기능을 제공합니다. 이러한 도구에 관한 자세한 내용은 cman_tool(8) 맨 페이지에서 참조하시기 바랍니다. |

fence_tool — Fence 도구 | Cluster Infrastructure | fence_tool 기본값으로된 fence 도메인 연결 또는 연결 해제에 사용되는 프로그램입니다. 특히, 이는 fence 데몬 (fenced)을 시작하여 도메인을 연결하고 fenced를 종료하여 도메인에서 연결 해제 합니다. 이 도구에 관한 자세한 내용은 fence_tool(8) 맨 페이지를 참조하시기 바랍니다. |

clustat — 클러스터 상태 유틸리티 | 고가용성 서비스 관리 구성 요소 | clustat 명령은 클러스터의 상태를 보여줍니다. 이는 멤버쉽 정보, 정족수 보기, 클러스터된 모든 사용자 서비스 상태를 보여줍니다. 이 도구에 관한 보다 자세한 내용은 clustat(8) 맨 페이지를 참조하시기 바랍니다. |

clusvcadm — 클러스터 사용자 서비스 관리 유틸리티 | 고가용성 서비스 관리 구성 요소 | clusvcadm 명령은 클러스터에서 고가용성 서비스를 활성, 비활성, 재배치, 재시작하게 합니다. 이 도구에 관한 보다 자세한 내용은 clusvcadm(8) 맨 페이지를 참조하시기 바랍니다. |

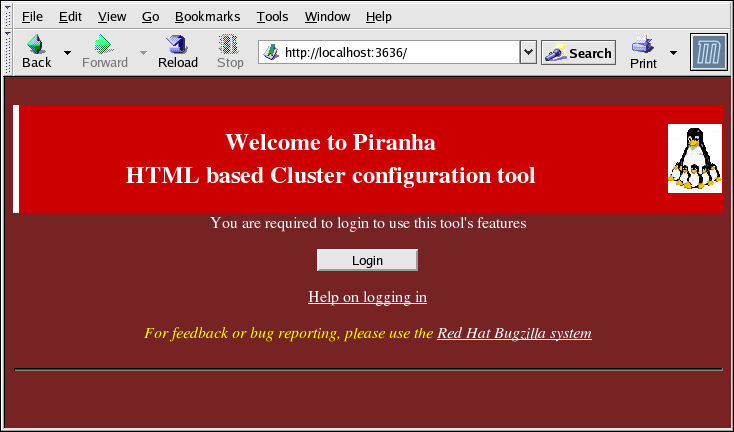

1.10. Linux 가상 서버 관리 GUI

/etc/sysconfig/ha/lvs.cf.

piranha-gui 서비스가 실행 중이어야 합니다. 웹 브라우져로Piranha Configuration Tool를 로컬이나 원격으로 액세스할 수 있습니다. 로컬로 액세스 하려면 URL: http://localhost:3636을 사용하고 원격으로 액세스하려면 호스트명이나 실제 IP 주소 뒤에 :3636을 더합니다. 원격으로 Piranha Configuration Tool를 액세스하려면 root로 활성화된 LVS 라우터에 ssh 연결을 해야 합니다.

그림 1.29. The Welcome Panel

1.10.1. CONTROL/MONITORING

pulse 데몬, LVS 라우팅 테이블, LVS 스폰 nanny 프로세스의 상태를 보여줍니다.

그림 1.30. The CONTROL/MONITORING Panel

- Auto update

- Update frequency in seconds (기본값은 10 초임) 텍스트 상자에 있는 사용자 설정 시간 간격에서 상태 보기가 자동으로 업데이트되도록 활성화합니다.10초 보다 짧게 자동 업데이트 간격을 설정하는 것은 좋지 않습니다. 이는 페이지가 너무 자주 업데이트되어 Auto update 간격을 재설정하기를 어렵게 만들기 때문입니다. 이러한 문제가 발생했을 경우, 다른 패널을 클릭한 후 CONTROL/MONITORING으로 다시 돌아옵니다.

- 상태 정보를 수동으로 업데이트합니다.

- 이 버튼을 클릭하면 Piranha Configuration Tool의 관리 암호를 변경하는 방법에 관한 내용이 있는 도움말 화면으로 이동합니다.

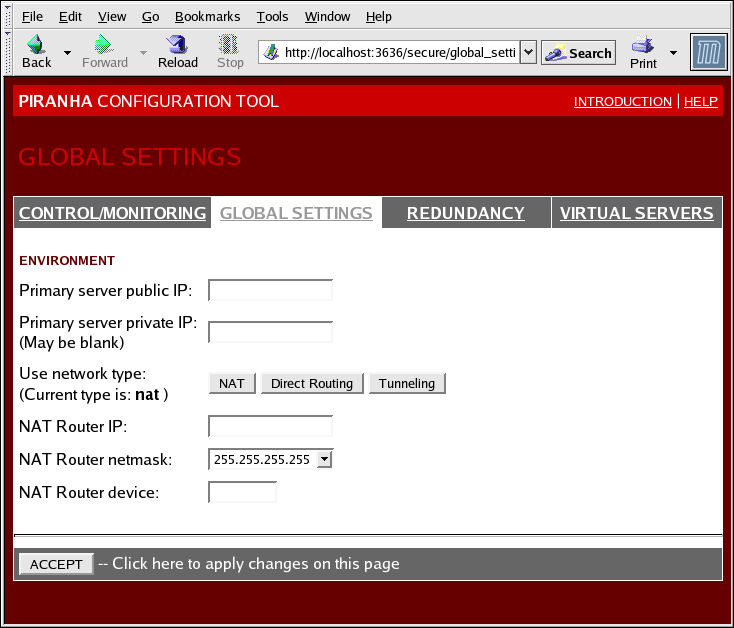

1.10.2. GLOBAL SETTINGS

그림 1.31. The GLOBAL SETTINGS Panel

- Primary server public IP

- 주요 LVS 노드에 해당하는 공개적으로 라우터 가능한 실제 IP 주소입니다.

- Primary server private IP

- 주요 LVS 노드에 있는 다른 네트워크 인터페이스의 실제 IP 주소입니다. 이 주소는 백업 라우터의 다른 하트비트 채널로서 단독으로 사용됩니다.

- Use network type

- NAT 라우팅을 선택합니다.

- NAT Router IP

- 개인 유동 IP를 입력합니다. 유동 IP는 실제 서버에 대해 게이트웨이로 사용되어야 합니다.

- NAT Router netmask

- If the NAT router's floating IP needs a particular netmask, select it from drop-down list.

- NAT Router device

eth1:1과 같이 유동 IP 주소에 해당하는 네트워크 인터페이스의 장치 이름을 정의합니다.

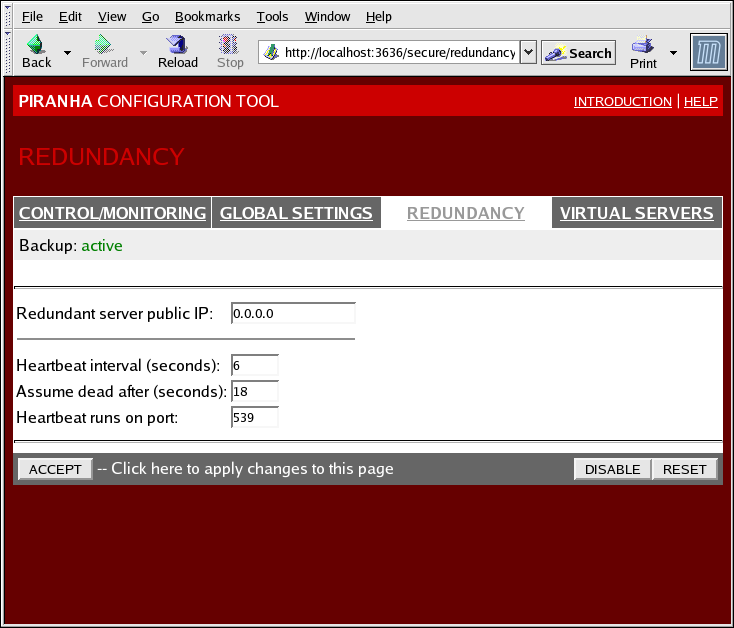

1.10.3. REDUNDANCY

그림 1.32. The REDUNDANCY Panel

- Redundant server public IP

- 백업 LVS 라우터 용 공개 실제 IP 주소

- Redundant server private IP

- The backup router's private real IP address.

- Heartbeat Interval (seconds)

- 하트비트 사이의 초 간격을 설정합니다 — 백업 노드가 주요 LVS 노드의 기능 상태를 점검하는 간격

- Assume dead after (seconds)

- 몇 초가 경과한 후 주요 LVS 노드가 응답하지 않을 경우, 백업 LVS 라우터 노드가 장애 조치를 시작하게 됩니다.

- Heartbeat runs on port

- 하트비트가 주요 LVS 노드외 통신하는 포트를 설정합니다. 빈 칸으로 되어 있을 경우 기본값으로 539를 설정합니다.

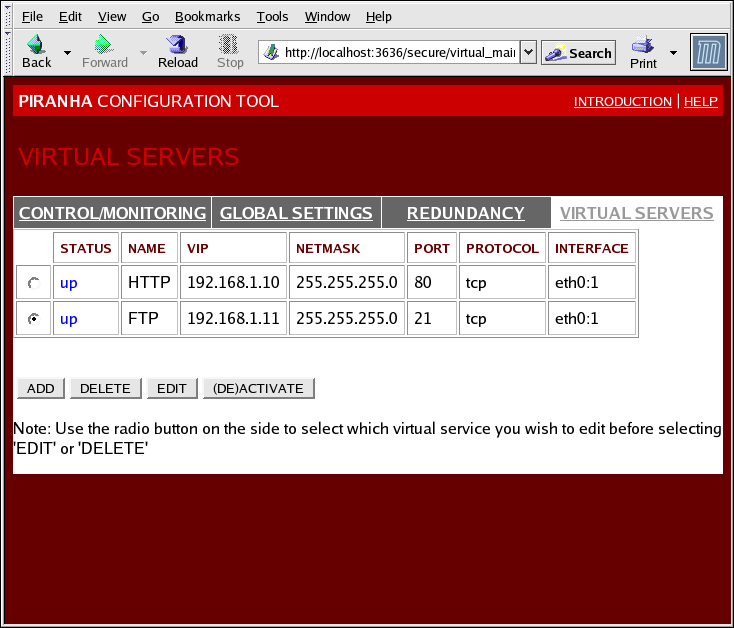

1.10.4. VIRTUAL SERVERS

그림 1.33. The VIRTUAL SERVERS Panel

1.10.4.1. VIRTUAL SERVER 하부 섹션

그림 1.34. The VIRTUAL SERVERS Subsection

- Name

- 가상 서버를 확인하기 위한 기술적인 이름. 이는 컴퓨터의 호스트명이 아니므로 기술적이고 식별하기 쉬운 것으로 정해야 합니다. HTTP와 같이 가상 서버로 사용된 프로토콜을 참조할 수 있습니다.

- Application port

- 서비스 어플리케이션이 청취할 포트 번호

- 드롭 다운 메뉴에서 UDP 또는 TCP를 선택

- Virtual IP Address

- The virtual server's floating IP address.

- 드롭 다운 메뉴에 있는 가상 서버의 넷 마스크

- Firewall Mark

- 프로토콜과 관련하여 다중 포트 프로토콜을 처리하거나 다중 포트 가상 서버를 분리하여 생성할 때 방화벽 표시 기능 정수값을 입력

- Device

- 바인드할 Virtual IP Address란에 지정하고자 하는 유동 IP주소에서 네트워크 장치 이름공개적 유동 IP 주소를 공개 네트워크에 연결된 이더넷 인터페이스에 알리아스해야 합니다.

- Re-entry Time

- 실제 서버 연결에 실패한 후 활성 LVS 라우터가 실제 서버를 사용하기 전 초 단위로 지정된 정수 값

- Service Timeout

- 실제 서버가 종료되었거나 사용 불가능하다고 판단하는 정수값으로된 초단위 시간

- Quiesce server

- Quiesce server 라디오 버튼이 선택되었을 경우, 아무때나 새로운 실제 서버 노드가 온라인이 될 수 있으며, 최소 연결 테이블은 0으로 재설정되어 활성화된 LVS 라우터는 모든 실제서버가 새로 클러스터에 추가된 것처럼 요청을 보냅니다. 이러한 옵션은 새로운 서버가 클러스터로 들어오는 최대 연결로 인해 교착 상태에 빠지지 않게 합니다.

- Load monitoring tool

- LVS 라우터는

rup또는ruptime을 사용하여 다양한 실제 서버 상의 로드를 모니터할 수 있습니다. 드롭 다운 메뉴에서rup를 선택했을 경우, 각각의 실제 서버는rstatd서비스를 실행해야만 합니다.ruptime을 선택했을 경우, 각각의 실제 서버는rwhod서비스를 실행해야 합니다. - Scheduling

- 드롭 다운 메뉴에서 선호하는 스케줄링 알고리즘. 기본값은

Weighted least-connection으로 되어 있습니다. - Persistence

- 클라이언트 트랜잭션 동안 가상 서버에 지속적 연결이 필요할 경우 사용합니다. 텍스트 란에 있는 연결 제한 시간 전에 경과 시간으로 허용된 비활성화 시간 (초 단위)을 지정합니다.

- 특정 서브넷에 지속성을 제한하기 위해 드롭다운 메뉴에서 적절한 네트워크 마스크를 선택합니다.

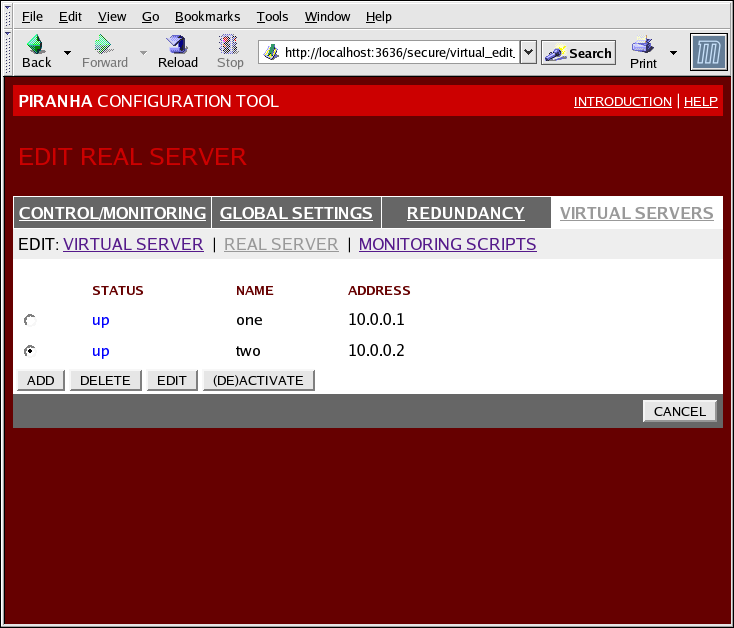

1.10.4.2. REAL SERVER 하부 섹션

그림 1.35. The REAL SERVER Subsection

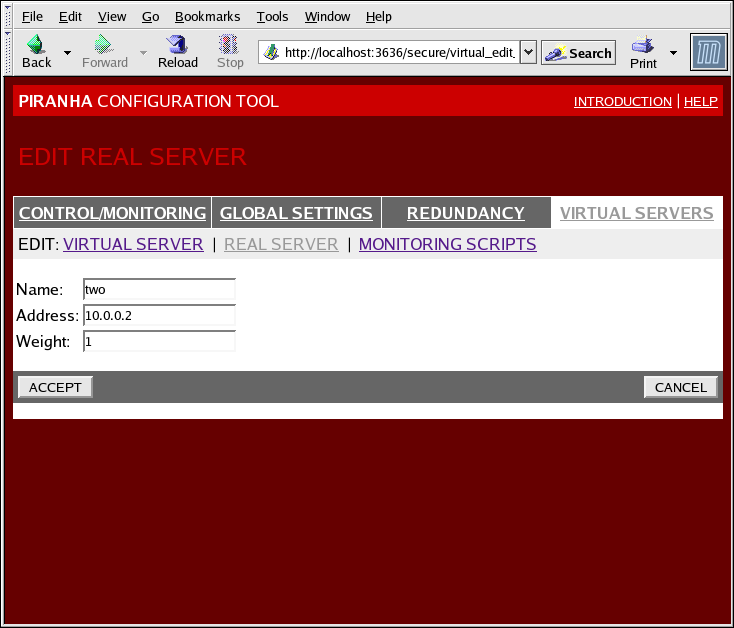

그림 1.36. The REAL SERVER Configuration Panel

- Name

- 실제 서버에 해당하는 기술적인 이름

참고

이 이름은 컴퓨터의 호스터명이 아니므로 기술적이고 쉽게 식별할 수 있는 것이어야 합니다. - Address

- The real server's IP address. Since the listening port is already specified for the associated virtual server, do not add a port number.

- Weight

- An integer value indicating this host's capacity relative to that of other hosts in the pool. The value can be arbitrary, but treat it as a ratio in relation to other real servers.

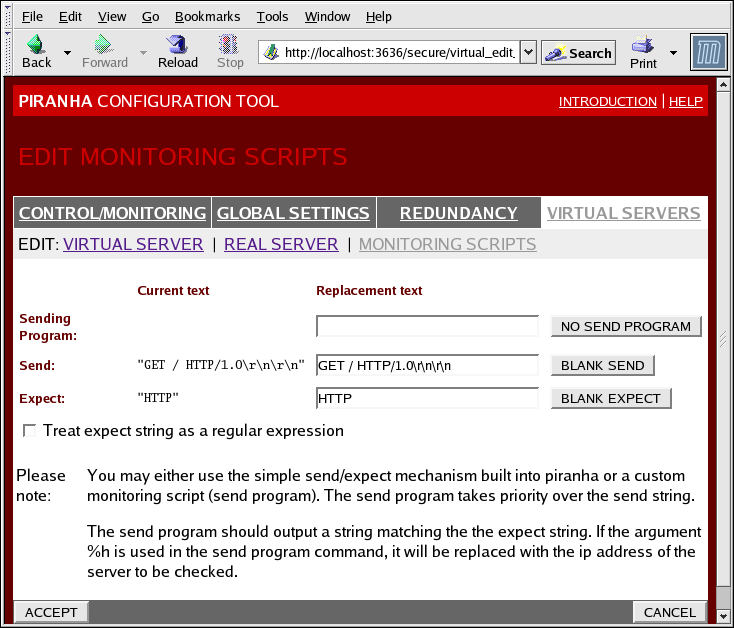

1.10.4.3. EDIT MONITORING SCRIPTS Subsection

그림 1.37. The EDIT MONITORING SCRIPTS Subsection

- Sending Program

- 보다 고급 서비스 인증을 위해 이 란에 서비스 확인 스크립트로의 경로를 지정할 수 있습니다. 특히 이러한 기능은 HTTPS 또는 SSL과 같이 역동적 데이터 변경을 필요로 하는 서비스에 유용합니다.이 기능을 사용하려면 스크립트를 작성해야 합니다. 이는 텍스트 응답 방식으로 복귀하고 실행 가능하게 설정되어 있어야 하며 Sending Program 란에 경로가 입력되어 있어야 합니다.

참고

외부 프로그램이 Sending Program 란에 입력되어 있을 경우 Send 란을 무시합니다. - Send

- 이 란에 있는 각각의 실제 서버로 보내기 위해

nanny데몬에 필요한 문자열입니다. 기본값으로 이 란은 HTTP로 되어 있습니다. 필요에 따라 이 값을 변경할 수 있습니다. 이 영역을 빈 칸으로 비워두었을 경우,nanny데몬은 포트를 열어 두어 서비스가 실행 되고 있다고 여깁니다.이 란에는 하나의 전송 순서만이 허용되며 인쇄할 수 있는 ASCII 문자와 다음과 같은 이스케이프 문자이어야만 합니다:- 새 줄 표시 경우 \n

- 캐리지 리턴 경우 \r

- 탭 경우 \t

- 그 다음으로 오는 문자를 생략할 경우 \

- Expect

- 서버가 올바르게 작동할 경우 텍스트 응답 방식으로 복귀해야 합니다. 독자적인 전송 프로그램을 사용할 경우, 전송 명령이 성공적으로 실행되었을 경우 이에 대한 응답을 입력합니다.

2장. Red Hat Cluster Suite 구성 요소 요약

2.1. 클러스터 구성 요소

| 기능 | 구성 요소 | 설명 |

|---|---|---|

| Conga | luci | 원격 관리 시스템 - 관리 스테이션 |

ricci | 원격 관리 시스템 - 관리화된 스테이션 | |

| Cluster Configuration Tool | system-config-cluster | 그래픽 설정에서 클러스터 설정 관리를 위해 사용되는 명령 |

| CLVM (Cluster Logical Volume Manager) | clvmd | 클러스터에서 LVM 메타데이터 업데이트를 사용하는 데몬. 이는 클러스터에 있는 모든 노드에서 실행되어야 하며 노드에서 이 데몬이 실행되고 있지 않을 경우 오류가 발생합니다. |

lvm | LVM2 도구. LVM2 용 명령행 도구 제공 | |

system-config-lvm | LVM2 용 그래픽 사용자 인터페이스 제공 | |

lvm.conf | LVM 설정 파일. 완전 경로는 /etc/lvm/lvm.conf.임. | |

| CCS (Cluster Configuration System) | ccs_tool | ccs_tool은 CCS (Cluster Configuration System)의 일부분으로 CCS 설정 파일의 온라인 업데이트에 사용됨. 또한 GFS 6.0 (및 이전 버전)으로 생성된 CCS 아카이브에서 이번 Red Hat Cluster Suite 릴리즈를 사용한 XML 포맷 설정으로 클러스터 설정 파일을 업그레이드하는데 사용될 수 있음. |

ccs_test | ccsd 를 통해 설정 파일 정보 검색에 사용되는 진단 및 테스팅 명령 | |

ccsd | 모든 클러스터 노드에서 실행되고 클러스터 소프트웨어에 설정 파일 데이터를 제공하는 CCS 데몬 | |

cluster.conf | 클러스터 설정 파일. 완전 경로는 /etc/cluster/cluster.conf임 | |

| CMAN (Cluster Manager) | cman.ko | CMAN 용 커널 모듈 |

cman_tool | CMAN에서의 관리용 프론트 엔드. CMAN을 시작하고 및 정지시키며 votes와 같은 내부적 매개 변수를 변경할 수 있음 | |

dlm_controld | 커널에 있는 dlm을 관리하기 위해 cman init 스크립트로 시작되는 데몬; 사용자에 의해 사용되지 않음 | |

gfs_controld | 커널에 있는 gfs를 관리하기 위해 cman init 스크립트로 시작되는 데몬; 사용자에 의해 사용되지 않음. | |

group_tool | fencing, DLM, GFS, 디버그 정보와 관련된 그룹 목록을 얻기 위해 사용됨; RHEL 4에서 어떤 cman_tool services가 제공되는지에 관한 정보도 얻을 수 있음 | |

groupd | openais/cman과 dlm_controld/gfs_controld/fenced 사이의 인터페이스에서 cman init 스크립트에 의해 시작되는 데몬; 사용자에 의해 사용되지 않음 | |

libcman.so.<version number> | cman.ko와의 통신에 필요한 프로그램 용 라이브러리 | |

| rgmanager (Resource Group Manager) | clusvcadm | 클러스터에서 수동으로 사용자 서비스를 활성화, 비활성화, 재배치, 재시작하는데 사용되는 명령 |

clustat | 노드 멤버쉽 및 서버스 실행을 포함한 클러스터의 상태를 나타내는데 사용되는 명령 | |

clurgmgrd | 서비스 시작, 서비스 비활성화, 서비스 재배치, 서비스 재시작을 포함하여 사용자 서비스 요청을 처리하기 위해 사용되는 데몬 | |

clurmtabd | 클러스터된 NFS 마운트 테이블을 처리하기 위해 사용되는 데몬 | |

| Fence | fence_apc | APC 전원 스위치 용 Fence 에이전트 |

fence_bladecenter | Telnet 인터페이스를 사용하는 IBM Bladecenters 용 Fence 에이전트 | |

fence_bullpap | Bull Novascale PAP (Platform Administration Processor) 인터페이스 용 Fence 에이전트 | |

fence_drac | DRAC (Dell Remote Access Card) 용 Fencing 에이전트 | |

fence_ipmilan | LAN을 통해 IPMI (Intelligent Platform Management Interface)에 의해 관리되는 컴퓨터에 해당하는 Fence 에이전트 | |

fence_wti | WTI 전원 스위치 용 Fence 에이전트 | |

fence_brocade | Brocade Fibre 채널 스위치 용 Fence 에이전트 | |

fence_mcdata | McData Fibre 채널 스위치 용 Fence 에이전트 | |

fence_vixel | Vixel Fibre 채널 스위치 용 Fence 에이전트 | |

fence_sanbox2 | SANBox2 Fibre 채널 스위치 용 Fence 에이전트 | |

fence_ilo | HP ILO 인터페이스 (이전에는 fence_rib) 용 Fence 에이전트 | |

fence_rsa | IBM RSA II 용 I/O Fencing 에이전트 | |

fence_gnbd | GNBD 스토리지와 함께 사용되는 Fence 에이전트 | |

fence_scsi | SCSI 영구 예약 용 I/O fencing 에이전트 | |

fence_egenera | Egenera BladeFrame 시스템과 함께 사용되는 Fence 에이전트 | |

fence_manual | 수동 인터렉션 용 Fence 에이전트. 알림 이는 제품 용으로 지원되지 않음 | |

fence_ack_manual | fence_manual 에이전트 용 사용자 인터페이스 | |

fence_node | 단일 노드에서 I/O fencing을 실행하는 프로그램 | |

fence_xvm | Xen 가상 머신 용 I/O Fencing 에이전트 | |

fence_xvmd | Xen 가상 머신 용 I/O Fencing 에이전트 호스트 | |

fence_tool | fence 데몬 연결 및 연결 해제 프로그램 | |

fenced | I/O Fencing 데몬 | |

| DLM | libdlm.so.<version number> | DLM (Distributed Lock Manager) 지원 용 라이브러리 |

| GFS | gfs.ko | GFS 파일 시스템을 실행하고 GFS 클러스터 노드로 읽어오는 커널 모듈 |

gfs_fsck | 마운트 해제된 GFS 파일 시스템 복구 명령 | |

gfs_grow | 마운트된 GFS 파일 시스템을 증가시키는 명령 | |

gfs_jadd | 마운트된 GFS 파일 시스템 저널 추가 명령 | |

gfs_mkfs | 스토리지에 GFS 파일 시스템 생성 명령 | |

gfs_quota | 마운트된 GFS 파일 시스템 쿼터 관리 명령 | |

gfs_tool | GFS 파일 시스템을 설정 또는 조정 명령. 이 명령으로 파일 시스템에 관한 다양한 정보를 얻을 수 있음 | |

mount.gfs | mount(8)로 볼 수 있는 마운트에 관한 도움말; 사용자에 의해 사용되지 않음 | |

| GNBD | gnbd.ko | 클라이언트에서 GNBD 장치 드라이버를 실행하는 커널 모듈. |

gnbd_export | GNBD 서버에서 GNBD를 생성하고 내보내며 관리하기 위한 명령 | |

gnbd_import | GNBD 클라이언트에서 GNBD를 관리하고 읽어오기 위한 명령 | |

gnbd_serv | 네트워크를 통해 로컬 스토리지를 내보내기 위해 노드를 허용하는 서버 데몬 | |

| LVS | pulse | This is the controlling process which starts all other daemons related to LVS routers. At boot time, the daemon is started by the /etc/rc.d/init.d/pulse script. It then reads the configuration file /etc/sysconfig/ha/lvs.cf. On the active LVS router, pulse starts the LVS daemon. On the backup router, pulse determines the health of the active router by executing a simple heartbeat at a user-configurable interval. If the active LVS router fails to respond after a user-configurable interval, it initiates failover. During failover, pulse on the backup LVS router instructs the pulse daemon on the active LVS router to shut down all LVS services, starts the send_arp program to reassign the floating IP addresses to the backup LVS router's MAC address, and starts the lvs daemon. |

lvsd | lvs 데몬이 일단 pulse에 의해 호출되면 활성화된 LVS 라우터에서 실행됩니다. 이는 /etc/sysconfig/ha/lvs.cf 설정 파일을 읽으며, ipvsadm 유틸리티를 호출하여 IPVS 라우팅 테이블을 생성하고 관리하며 각각의 설정된 LVS 서비스 용 nanny 프로세스를 지정합니다. nanny가 서버가 다운되었다고 보고하면 lvs가 ipvsadm 유틸리티를 지시하여 IPVS 라우팅 테이블에서 서버를 삭제합니다. | |

ipvsadm | 커널에서 IPVS 라우팅 테이블을 업데이트함. lvs 데몬은 IPVS 라운팅 페이블에 있는 항목을 추가, 변경, 삭제하기 위해 ipvsadm 명령을 호출하여 LVS를 설정 및 관리함. | |

nanny | nanny 모니터링 데몬은 LVS 라우트에서 실행됨. 이 데몬을 통해, 활성화된 LVS 라우터는 실제 서버 상태를 결정하며, 옵션으로 작업량을 모니터함. 분리된 프로세스는 실제 서버에 정의된 각각의 서비스에 대해 실행됨. | |

lvs.cf | LVS 설정 파일로 완전 경로는 /etc/sysconfig/ha/lvs.cf임. 직접 또는 간접적으로 모든 데몬은 이 파일에서 파일 설정 정보를 얻음. | |

| Piranha Configuration Tool | LVS 모니터링, 설정, 관리 용 웹 기반 도구로 /etc/sysconfig/ha/lvs.cf LVS 설정 파일을 관리하기 위한 기본값 도구. | |

send_arp | 이 프로그램은 장애조치 중 하나의 노드에서 다른 노드로 유동 IP 주소가 변경되었을때 ARP 브로드캐스트를 전송함. | |

| Quorum 디스크 | qdisk | CMAN / Linux-Cluster 용 디스크 기반 quorum 데몬 |

mkqdisk | 클러스터 Quorum 디스크 유틸리티 | |

qdiskd | 클러스터 Quorum 디스크 데몬 |

2.2. 맨 페이지

- 클러스터 인프라

- ccs_tool (8) - CCS 설정 파일의 온라인 업데이트를 위해 사용되는 도구

- ccs_test (8) - 클러스터 설정 시스템 실행을 위한 진단 도구

- ccsd (8) - CCS 클러스터 설정 파일 액세스에 사용되는 데몬

- ccs (7) - 클러스터 설정 시스템

- cman_tool (8) - 클러스터 관리 도구

- cluster.conf [cluster] (5) - 클러스터 제품 용 설정 파일

- qdisk (5) - CMAN / Linux-Cluster 용 디스크 기반 quorum 데몬

- mkqdisk (8) - 클러스터 Quorum 디스크 유틸리티

- qdiskd (8) - 클러스터 Quorum 디스크 데몬

- fence_ack_manual (8) - 수동 I/O Fencing으로서 오퍼레이터에 의해 실행되는 프로그램

- fence_apc (8) - APC MasterSwitch 용 I/O Fencing 에이전트

- fence_bladecenter (8) - IBM Bladecenter 용 I/O Fencing 에이전트

- fence_brocade (8) - Brocade FC 스위치 용 I/O Fencing 에이전트

- fence_bullpap (8) - PAP 관리 콘솔에 의해 제어되는 Bull FAME 아키텍쳐 용 I/O Fencing 에이전트

- fence_drac (8) - Dell Remote Access Card 용 fencing 에이전트

- fence_egenera (8) - Egenera BladeFrame 용 I/O Fencing 에이전트

- fence_gnbd (8) - GNBD 기반 GFS 클러스터 용 I/O Fencing 에이전트

- fence_ilo (8) - HP Integrated Lights Out Card 용 I/O Fencing 에이전트

- fence_ipmilan (8) - LAN을 통해 IPMI에 의해 제어되는 기계 장치 용 I/O Fencing 에이전트

- fence_manual (8) - 수동 I/O Fencing 부분으로 fenced에 의해 실행되는 프로그램

- fence_mcdata (8) - McData FC 스위치 용 I/O Fencing 에이전트

- fence_node (8) - 단일 노드에서 I/O fencing을 실행하는 프로그램

- fence_rib (8) - Compaq Remote Insight Lights Out Card 용 I/O Fencing 에이전트

- fence_rsa (8) - IBM RSA II 용 I/O Fencing 에이전트

- fence_sanbox2 (8) - QLogic SANBox2 FC 스위치 용 I/O Fencing 에이전트

- fence_scsi (8) - SCSI 영구 예약 용 I/O fencing 에이전트

- fence_tool (8) - fence 데몬 연결 및 연결 해제 프로그램

- fence_vixel (8) - Vixel FC 스위치 용 I/O Fencing 에이전트

- fence_wti (8) - WTI Network Power Switch 용 I/O Fencing 에이전트

- fence_xvm (8) - Xen 가상 머신 용 I/O Fencing 에이전트

- fence_xvmd (8) - Xen 가상 머신 용 I/O Fencing 에이전트

- fenced (8) - I/O Fencing 데몬

- 고가용성 서비스 관리

- clusvcadm (8) - 클러스터 사용자 서비스 관리 유틸리티

- clustat (8) - 클러스터 상태 유틸리티

- Clurgmgrd [clurgmgrd] (8) - 리소스 그룹 (클러스터 서비스) 관리자 데몬

- clurmtabd (8) - 클러스터 NFS 원격 마운트 테이블 데몬

- GFS

- gfs_fsck (8) - 오프라인 GFS 파일 시스템 확인

- gfs_grow (8) - GFS 파일 시스템 확장

- gfs_jadd (8) - GFS 파일 시스템에 저널 추가

- gfs_mount (8) - GFS 마운트 옵션

- gfs_quota (8) - GFS 디스크 쿼터 조작

- gfs_tool (8) - gfs ioctl 호출에서의 인터페이스

- CLVM (Cluster Logical Volume Manager)

- clvmd (8) - 클러스터 LVM 데몬

- lvm (8) - LVM2 도구

- lvm.conf [lvm] (5) - LVM2 용 설정 파일

- lvmchange (8) - 논리 볼륨 관리자의 속성 변경

- pvcreate (8) - LVM 사용을 위한 디스크 또는 파티션 초기화

- lvs (8) - 논리 볼륨에 관한 내용 보고

- GNBD (Global Network Block Device)

- gnbd_export (8) - GNBD를 내보내기 위한 인터페이스

- gnbd_import (8) - 클라이언트에서 GNBD 블럭 장치 조작

- gnbd_serv (8) - gnbd 서버 데몬

- LVS

- pulse (8) - 클러스터 노드의 상태를 모니터링하기 위한 heartbeating 데몬

- lvs.cf [lvs] (5) - lvs 용 설정 파일

- lvscan (8) - 논리 볼륨을 위해 (모든 디스크를) 스캔

- lvsd (8) - Red Hat 클러스터링 서비스를 제어하기 위한 데몬

- ipvsadm (8) - Linux 가상 서버 관리

- ipvsadm-restore (8) - stdin에서 IPVS 테이블 복구

- ipvsadm-save (8) - stdout에 IPVS 테이블 저장

- nanny (8) - 클러스터에 있는 서비스의 상태를 모니터하기 위한 도구

- send_arp (8) - 새 IP 주소 / MAC 주소 맵핑을 위한 네트워크 확인 도구

2.3. 하드웨어 호환성

부록 A. 개정 내역

| 고친 과정 | |||

|---|---|---|---|

| 고침 3-8.400 | 2013-10-31 | ||

| |||

| 고침 3-8 | 2012-07-18 | ||

| |||

| 고침 1.0-0 | Tue Jan 20 2008 | ||

| |||

색인

C

- cluster

- displaying status, Cluster Status Tool

- cluster administration

- displaying cluster and service status, Cluster Status Tool

- cluster component compatible hardware, 하드웨어 호환성

- cluster component man pages, 맨 페이지

- cluster components table, 클러스터 구성 요소

- Cluster Configuration Tool

- accessing, Cluster Configuration Tool

- cluster service

- displaying status, Cluster Status Tool

- command line tools table, 명령행 관리 도구

- compatible hardware

- cluster components, 하드웨어 호환성

- Conga

- overview, Conga

- Conga overview, Conga

F

- feedback, 피드백

L

- LVS

- direct routing

- routing methods

- NAT, 라우팅 방식

- three tiered

- high-availability cluster, Three-Tier LVS Topology

M

- man pages

- cluster components, 맨 페이지

N

- NAT

- routing methods, LVS, 라우팅 방식

- network address translation (살펴볼 내용 NAT)

O

- overview

- economy, Red Hat GFS

- performance, Red Hat GFS

- scalability, Red Hat GFS

P

- Piranha Configuration Tool

- CONTROL/MONITORING, CONTROL/MONITORING

- EDIT MONITORING SCRIPTS Subsection, EDIT MONITORING SCRIPTS Subsection

- GLOBAL SETTINGS, GLOBAL SETTINGS

- login panel, Linux 가상 서버 관리 GUI

- necessary software, Linux 가상 서버 관리 GUI

- REAL SERVER subsection, REAL SERVER 하부 섹션

- REDUNDANCY, REDUNDANCY

- VIRTUAL SERVER subsection, VIRTUAL SERVERS

- Firewall Mark , VIRTUAL SERVER 하부 섹션

- Persistence , VIRTUAL SERVER 하부 섹션

- Scheduling , VIRTUAL SERVER 하부 섹션

- Virtual IP Address , VIRTUAL SERVER 하부 섹션

- VIRTUAL SERVERS, VIRTUAL SERVERS

R

- Red Hat Cluster Suite

- components, 클러스터 구성 요소

T

- table

- cluster components, 클러스터 구성 요소

- command line tools, 명령행 관리 도구