1.7. 集群生命周期简介

multicluster engine operator 是集群生命周期 Operator,它为 OpenShift Container Platform 和 Red Hat Advanced Cluster Management hub 集群提供集群管理功能。multicluster engine operator 是一个软件 Operator,它增强了集群集管理,并支持跨云和数据中心的 OpenShift Container Platform 集群生命周期管理。您可以在没有 Red Hat Advanced Cluster Management 的情况下使用 multicluster engine operator。Red Hat Advanced Cluster Management 还自动安装多集群引擎 operator,并提供进一步的多集群功能。

请参阅以下文档:

1.7.1. 集群生命周期架构

集群生命周期需要两种类型的集群:hub 集群和受管集群。

hub 集群是带有 multicluster engine operator 的 OpenShift Container Platform (或 Red Hat Advanced Cluster Management)主集群。您可以使用 hub 集群创建、管理和监控其他 Kubernetes 集群。您可以使用 hub 集群创建集群,同时也可以导入现有集群由 hub 集群管理。

在创建受管集群时,集群会使用 Hive 资源的 Red Hat OpenShift Container Platform 集群安装程序创建集群。您可以通过阅读 OpenShift Container Platform 文档中的安装 概述 来找到有关使用 OpenShift Container Platform 安装程序安装集群的过程的更多信息。

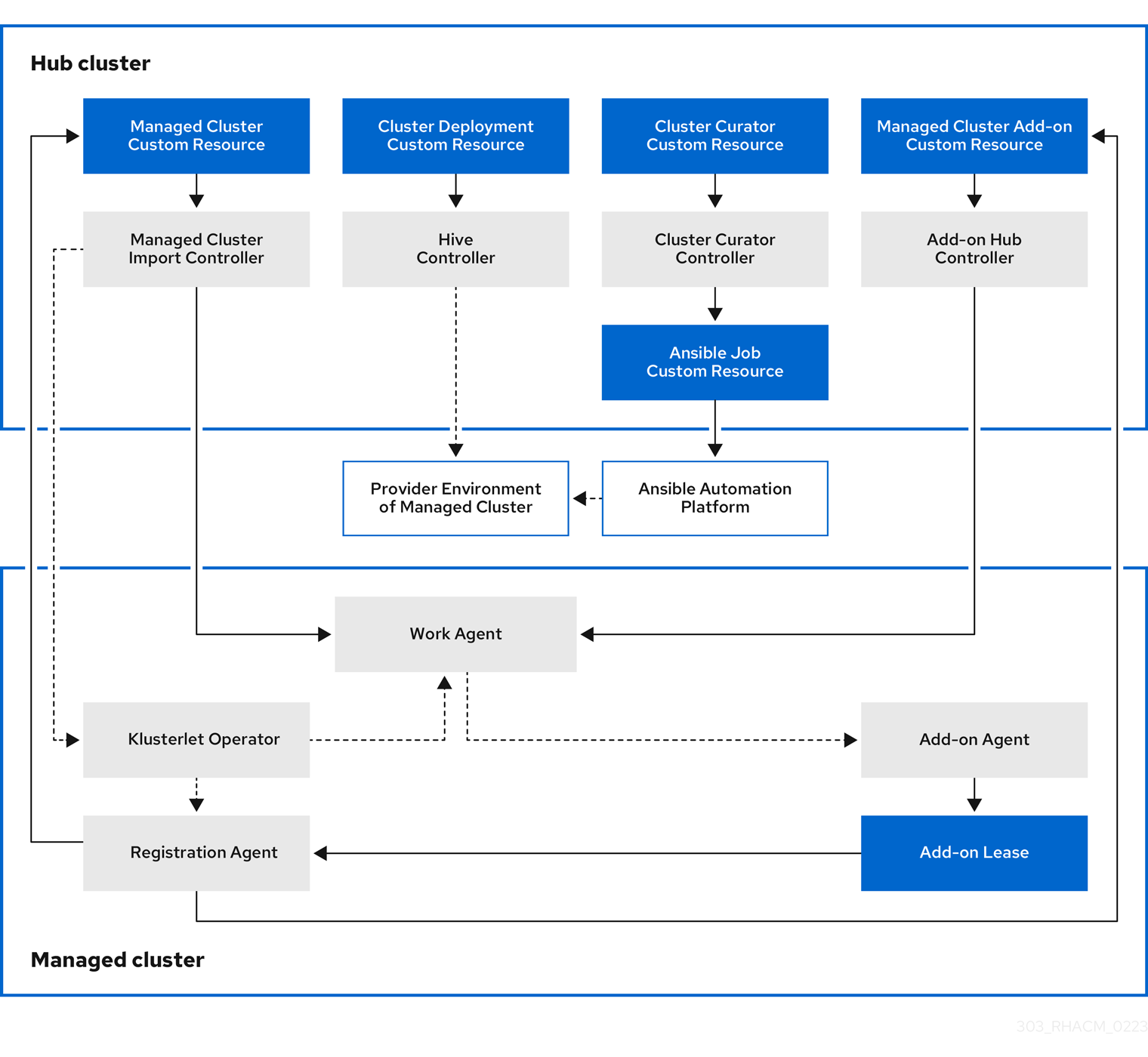

下图显示了为集群管理的 multicluster engine 安装的组件:

集群生命周期管理架构的组件包括以下项目:

1.7.1.1. hub 集群

- 受管集群导入控制器将 klusterlet Operator 部署到受管集群。

- Hive 控制器使用 Kubernetes operator 的多集群引擎置备您创建的集群。Hive Controller 还销毁由 Kubernetes operator 的多集群引擎创建的受管集群。

- 集群 curator 控制器将 Ansible 作业创建为 pre-hook 或 post-hook,以便在创建或升级受管集群时配置集群基础架构环境。

- 当在 hub 集群中启用了受管集群附加组件时,会在 hub 集群中部署其 附加组件 hub 控制器。附加组件 hub 控制器将附加组件代理 部署到受管集群。

1.7.1.2. 受管集群(managed cluster)

- klusterlet Operator 在受管集群中部署注册和工作控制器。

Registration Agent 将受管集群和受管集群附加组件注册到 hub 集群。Registration Agent 还维护受管集群和受管集群附加组件的状态。以下权限会在 Clusterrole 中自动创建,以允许受管集群访问 hub 集群:

- 允许代理获取或更新 hub 集群管理的所有权集群

- 允许代理更新 hub 集群管理的拥有集群状态

- 允许代理轮转其证书

-

允许代理

get或updatecoordination.k8s.io租期 -

允许代理

get受管集群附加组件 - 允许代理更新其受管集群附加组件的状态

- 工作代理将 Add-on Agent 应用到受管集群。允许受管集群访问 hub 集群的权限会在 Clusterrole 中自动创建,并允许代理向 hub 集群发送事件。

要继续添加和管理集群,请参阅集群生命周期简介。

1.7.2. 发行镜像

构建集群时,请使用发行镜像指定的 Red Hat OpenShift Container Platform 版本。默认情况下,OpenShift Container Platform 使用 clusterImageSets 资源来获取支持的发行镜像列表。

继续阅读以了解更多有关发行镜像的信息:

1.7.2.1. 指定发行镜像

当使用 multicluster engine for Kubernetes operator 在供应商处创建集群时,请指定用于新集群的发行镜像。要指定发行镜像,请参阅以下主题:

1.7.2.1.1. 查找 ClusterImageSets

引用发行镜像的 YAML 文件在 acm-hive-openshift-releases GitHub 仓库中维护。这些文件用于在控制台中创建可用发行镜像的列表。这包括 OpenShift Container Platform 的最新快速频道镜像。

控制台仅显示三个 OpenShift Container Platform 最新版本的最新发行镜像。例如,您可能在控制台选项中看到以下发行镜像:

quay.io/openshift-release-dev/ocp-release:4.15.1-x86_64

控制台会显示最新版本,以帮助您使用最新发行镜像创建集群。如果您需要创建特定版本的集群,也可使用旧的发行镜像版本。

注: 您只能在控制台中创建集群时选择带有 visible: 'true' 标签的镜像。ClusterImageSet 资源中的此标签示例在以下内容中提供。将 4.x.1 替换为该产品的当前版本:

apiVersion: hive.openshift.io/v1

kind: ClusterImageSet

metadata:

labels:

channel: fast

visible: 'true'

name: img4.x.1-x86-64-appsub

spec:

releaseImage: quay.io/openshift-release-dev/ocp-release:4.x.1-x86_64存储了额外的发行镜像,但无法在控制台中看到。要查看所有可用发行镜像,请运行以下命令:

oc get clusterimageset

存储库具有 clusterImageSets 目录,这是您在使用发行镜像时使用的目录。clusterImageSets 目录具有以下目录:

- Fast:包含引用每个支持的 OpenShift Container Platform 版本最新版本的发行镜像的文件。此目录中的发行镜像经过测试、验证和支持。

Releases:包含引用每个 OpenShift Container Platform 版本(stable、fast 和 candidate 频道)的所有发行镜像的文件。

注意:这些发行版本尚未全部经过测试并确定是稳定的。

stable :包含引用每个支持的 OpenShift Container Platform 版本的最新两个稳定发行镜像版本的文件。

注: 默认情况下,当前发行镜像列表每小时更新一次。升级产品后,列表最多可能需要一小时,以反映该产品的新版本的建议发行镜像版本。

1.7.2.1.2. 配置 ClusterImageSets

您可以使用以下选项配置 ClusterImageSets :

选项 1: 要在控制台中创建集群,请指定您要我们的特定

ClusterImageSet的镜像引用。您指定的每个新条目都会保留,并可用于将来的所有集群。详情请参阅以下示例条目:quay.io/openshift-release-dev/ocp-release:4.6.8-x86_64-

选项 2:手动创建,应用来自

acm-hive-openshift-releasesGitHub 仓库的ClusterImageSetsYAML 文件。 -

选项 3: 要从 fork 的 GitHub 仓库中启用

ClusterImageSets的自动更新,请按照 cluster-image-set-controller GitHub 仓库中的README.md进行操作。

1.7.2.1.3. 创建发行镜像以在不同构架中部署集群

您可以通过手动创建具有这两个架构文件的发行镜像,在与 hub 集群架构不同的架构中创建集群。

例如,您可以从 ppc64le、aarch64 或 s390x 架构上运行的 hub 集群创建一个 x86_64 集群。如果使用两组文件创建发行镜像,集群创建成功,因为新发行镜像启用 OpenShift Container Platform 发行 registry 来提供多架构镜像清单。

OpenShift Container Platform 默认支持多个架构。您可以使用以下 clusterImageSet 来置备集群。将 4.x.0 替换为当前支持的版本:

apiVersion: hive.openshift.io/v1

kind: ClusterImageSet

metadata:

labels:

channel: fast

visible: 'true'

name: img4.x.0-multi-appsub

spec:

releaseImage: quay.io/openshift-release-dev/ocp-release:4.x.0-multi要为不支持多个架构的 OpenShift Container Platform 镜像创建发行镜像,请完成类似以下示例的步骤:

在 OpenShift Container Platform release registry 中,创建一个 清单列表,其中包含

x86_64、s390x、aarch64和ppc64le发行镜像。通过运行以下示例命令,从 Quay 存储库拉取 环境中这两个架构的清单列表。将

4.x.1替换为该产品的当前版本:podman pull quay.io/openshift-release-dev/ocp-release:4.x.1-x86_64 podman pull quay.io/openshift-release-dev/ocp-release:4.x.1-ppc64le podman pull quay.io/openshift-release-dev/ocp-release:4.x.1-s390x podman pull quay.io/openshift-release-dev/ocp-release:4.x.1-aarch64运行以下命令,登录到您维护镜像的私有存储库。将

<private-repo> 替换为存储库的路径:podman login <private-repo>运行以下命令,将发行镜像清单添加到私有存储库中。将

4.x.1替换为该产品的当前版本。将<private-repo> 替换为存储库的路径:podman push quay.io/openshift-release-dev/ocp-release:4.x.1-x86_64 <private-repo>/ocp-release:4.x.1-x86_64 podman push quay.io/openshift-release-dev/ocp-release:4.x.1-ppc64le <private-repo>/ocp-release:4.x.1-ppc64le podman push quay.io/openshift-release-dev/ocp-release:4.x.1-s390x <private-repo>/ocp-release:4.x.1-s390x podman push quay.io/openshift-release-dev/ocp-release:4.x.1-aarch64 <private-repo>/ocp-release:4.x.1-aarch64运行以下命令,为新信息创建清单:

podman manifest create mymanifest运行以下命令,将两个发行镜像的引用添加到清单列表中。将

4.x.1替换为该产品的当前版本。将<private-repo> 替换为存储库的路径:podman manifest add mymanifest <private-repo>/ocp-release:4.x.1-x86_64 podman manifest add mymanifest <private-repo>/ocp-release:4.x.1-ppc64le podman manifest add mymanifest <private-repo>/ocp-release:4.x.1-s390x podman manifest add mymanifest <private-repo>/ocp-release:4.x.1-aarch64运行以下命令,将清单列表中的列表与现有清单合并。将

<private-repo> 替换为存储库的路径。将4.x.1替换为当前版本:podman manifest push mymanifest docker://<private-repo>/ocp-release:4.x.1

在 hub 集群中,创建一个发行版本镜像来引用存储库中的清单。

创建一个 YAML 文件,其中包含类似以下示例的信息。将

<private-repo> 替换为存储库的路径。将4.x.1替换为当前版本:apiVersion: hive.openshift.io/v1 kind: ClusterImageSet metadata: labels: channel: fast visible: "true" name: img4.x.1-appsub spec: releaseImage: <private-repo>/ocp-release:4.x.1在 hub 集群中运行以下命令以应用更改。将 <

;file-name> 替换为您在上一步中创建的 YAML 文件的名称:oc apply -f <file-name>.yaml

- 在创建 OpenShift Container Platform 集群时选择新的发行镜像。

- 如果使用 Red Hat Advanced Cluster Management 控制台部署受管集群,在集群创建过程中在 Architecture 字段中指定受管集群的架构。

创建流程使用合并的发行镜像来创建集群。

1.7.2.1.4. 其他资源

- 有关引用发行镜像的 YAML 文件,请参阅 acm-hive-openshift-releases GitHub 仓库。

-

请参阅 cluster-image-set-controller GitHub 存储库,了解如何启用来自 fork 的 GitHub 仓库的

ClusterImageSets资源的自动更新。

1.7.2.2. 连接时维护自定义的发行镜像列表

您可能想要在所有集群中使用相同的发行镜像。为简化操作,您可以创建自己的自定义列表,在其中包含创建集群时可用的发行镜像。完成以下步骤以管理可用发行镜像:

- 对 acm-hive-openshift-releases GitHub 进行分叉。

-

为创建集群时可用的镜像添加 YAML 文件。使用 Git 控制台或终端将镜像添加到

./clusterImageSets/stable/或./clusterImageSets/fast/目录中。 -

在

multicluster-engine命名空间中创建一个名为cluster-image-set-git-repo的ConfigMap。请参见以下示例,但将2.x替换为 2.7:

apiVersion: v1

kind: ConfigMap

metadata:

name: cluster-image-set-git-repo

namespace: multicluster-engine

data:

gitRepoUrl: <forked acm-hive-openshift-releases repository URL>

gitRepoBranch: backplane-<2.x>

gitRepoPath: clusterImageSets

channel: <fast or stable>您可以按照以下流程将更改合并到已分叉的存储库,从主存储库检索可用的 YAML 文件:

- 将更改提交并合并到您的已分叉仓库。

-

要在克隆

acm-hive-openshift-releases仓库后同步 fast 发行镜像列表,请将cluster-image-set-git-repoConfigMap中的 channel 字段的值更新为fast。 -

要同步并显示 stable 发行镜像,请将

cluster-image-set-git-repoConfigMap中的 channel 字段的值更新为stable。

更新 ConfigMap 后,可用稳定镜像列表会在约一分钟内更新为当前可用镜像。

您可以使用以下命令列出可用内容并删除默认值。将

<clusterImageSet_NAME>替换为正确的名称:oc get clusterImageSets oc delete clusterImageSet <clusterImageSet_NAME>

在创建集群时,在控制台中查看当前可用发行镜像的列表。

有关通过 ConfigMap 提供的其他字段的信息,请查看 cluster-image-set-controller GitHub 仓库 README。

1.7.2.3. 断开连接时维护自定义的发行镜像列表

在某些情况下,当节点集群没有互联网连接时,您需要维护一个自定义的发行镜像列表。您可以创建自己的自定义列表,在其中包含创建集群时可用的发行镜像。完成以下步骤以在断开连接的情况下管理可用发行镜像:

- 当您位于连接的系统中时,进入 acm-hive-openshift-releases GitHub 仓库 来访问可用的集群镜像集。

-

将

clusterImageSets目录复制到可以访问断开连接的多集群引擎 operator 集群的系统中。 通过完成以下步骤,添加受管集群和带有集群镜像的断开连接的存储库之间的映射:

-

对于 OpenShift Container Platform 受管集群,请参阅配置镜像 registry 存储库镜像,以了解有关使用

ImageContentSourcePolicy对象完成映射的信息。 -

对于不是 OpenShift Container Platform 集群的受管集群,请使用

ManageClusterImageRegistry自定义资源定义来覆盖镜像集的位置。如需有关如何 为映射覆盖集群的信息,请参阅指定受管集群中的 registry 镜像。

-

对于 OpenShift Container Platform 受管集群,请参阅配置镜像 registry 存储库镜像,以了解有关使用

-

使用控制台或 CLI 为您希望在创建集群时可用的镜像添加 YAML 文件,以手动添加

clusterImageSetYAML 内容。 修改 OpenShift Container Platform 发行镜像的

clusterImageSetYAML 文件,以引用存储镜像的正确离线存储库。您的更新类似以下示例,其中spec.releaseImage使用发行镜像的离线镜像 registry,发行镜像由摘要引用:apiVersion: hive.openshift.io/v1 kind: ClusterImageSet metadata: labels: channel: fast name: img<4.x.x>-x86-64-appsub spec: releaseImage: IMAGE_REGISTRY_IPADDRESS_or__DNSNAME/REPO_PATH/ocp-release@sha256:073a4e46289be25e2a05f5264c8f1d697410db66b960c9ceeddebd1c61e58717- 确保在 YAML 文件中引用的离线镜像 registry 中载入镜像。

运行以下命令来获取镜像摘要:

oc adm release info <tagged_openshift_release_image> | grep "Pull From"将

<tagged_openshift_release_image> 替换为受支持的 OpenShift Container Platform 版本标记的镜像。请参见以下示例输出:Pull From: quay.io/openshift-release-dev/ocp-release@sha256:69d1292f64a2b67227c5592c1a7d499c7d00376e498634ff8e1946bc9ccdddfe如需了解更多有关镜像标签和摘要的信息,请参阅镜像流中的镜像。

通过为每个

YAML文件输入以下命令来创建每个 clusterImageSets:oc create -f <clusterImageSet_FILE>将

clusterImageSet_FILE替换为集群镜像集文件的名称。例如:oc create -f img4.11.9-x86_64.yaml为要添加的每个资源运行此命令后,可用发行镜像列表可用。

-

另外,您还可以将镜像 URL 直接粘贴到创建集群控制台中。如果镜像 URL 不存在,则添加镜像 URL 会创建新的

clusterImageSets。 - 在创建集群时,在控制台中查看当前可用发行镜像的列表。

1.7.2.4. 同步可用发行镜像

如果您有 Red Hat Advanced Cluster Management hub 集群,它使用 MultiClusterHub operator 来管理、升级和安装 hub 集群组件,您可以同步发行镜像列表,以确保可以选择最新的可用版本。发行镜像位于 acm-hive-openshift-releases 仓库中,并经常更新。

1.7.2.4.1. 稳定性级别

发行镜像有三个级别的稳定性,如下表中所示:

| 类别 | 描述 |

|---|---|

| candidate | 当前没有测试的镜像,可能有一些程序错误。 |

| fast | 部分测试的镜像,但稳定性可能低于稳定版本。 |

| stable | 已确认这些完全测试的镜像以正确安装和构建集群。 |

1.7.2.4.2. 刷新发行镜像列表

完成以下步骤,使用 Linux 或 Mac 操作系统刷新和同步镜像列表:

-

如果启用了安装程序管理的

acm-hive-openshift-releases订阅,在MultiClusterHub资源中将disableUpdateClusterImageSets的值设置为true来禁用订阅。 - 克隆 acm-hive-openshift-releases GitHub 仓库。

运行以下命令来删除订阅:

oc delete -f subscribe/subscription-fast要同步并显示

candidate发行镜像,请使用 Linux 或 Mac 操作系统运行以下命令:make subscribe-candidate大约一分钟后,提供

候选发行镜像的最新列表。要同步并显示

fast发行镜像,请运行以下命令:make subscribe-fast大约一分钟后,最新的

fast发行镜像列表将可用。连接到

稳定发行镜像并同步您的 Red Hat Advanced Cluster Management hub 集群。使用 Linux 或 Mac 操作系统运行以下命令:make subscribe-stable大约一分钟后,当前可用的镜像会更新可用

candidate、fast和stable发行镜像的列表。- 在创建集群时,查看 Red Hat Advanced Cluster Management 控制台中当前可用发行镜像的列表。

运行以下命令,取消订阅这些频道以停止查看更新:

oc delete -f subscribe/subscription-fast

1.7.3. 创建集群

了解如何使用多集群引擎 operator 在云供应商中创建 Red Hat OpenShift Container Platform 集群。

multicluster engine operator 使用 OpenShift Container Platform 提供的 Hive operator 为除内部集群和托管 control plane 以外的所有供应商置备集群。在置备内部集群时,多集群引擎 operator 使用 OpenShift Container Platform 提供的中央基础架构管理和辅助安装程序功能。托管 control plane 托管的集群使用 HyperShift operator 置备。

1.7.3.1. 使用 CLI 创建集群

Kubernetes operator 的多集群引擎使用内部 Hive 组件来创建 Red Hat OpenShift Container Platform 集群。请参阅以下信息以了解如何创建集群。

1.7.3.1.1. 先决条件

在创建集群前,您必须克隆 clusterImageSets 存储库,并将其应用到 hub 集群。完成以下步骤:

运行以下命令来克隆,但将

2.x替换为您的 multicluster engine operator 版本:git clone https://github.com/stolostron/acm-hive-openshift-releases.git cd acm-hive-openshift-releases git checkout origin/backplane-<2.x>- 运行以下命令将其应用到 hub 集群:

find clusterImageSets/fast -type d -exec oc apply -f {} \; 2> /dev/null在创建集群时选择 OpenShift Container Platform 发行镜像。

注: 如果使用 Nutanix 平台,请确保将

x86_64架构用于ClusterImageSet资源中的releaseImage,并将visible标签值设置为'true'。请参见以下示例:apiVersion: hive.openshift.io/v1 kind: ClusterImageSet metadata: labels: channel: stable visible: 'true' name: img4.x.47-x86-64-appsub spec: releaseImage: quay.io/openshift-release-dev/ocp-release:4.x.47-x86_64-

查看 hub 集群

KubeAPIServer证书验证策略,以确保默认的UseAutoDetectedCABundle策略可以正常工作。如果需要手动更改策略,请参阅配置 hub 集群KubeAPIServer验证策略。

1.7.3.1.2. 使用 ClusterDeployment 创建集群

ClusterDeployment 是一个 Hive 自定义资源,用于控制集群的生命周期。

按照 使用 Hive 文档创建 ClusterDeployment 自定义资源并创建单个集群。

1.7.3.1.3. 使用 ClusterPool 创建集群

ClusterPool 也是用于创建多个集群的 Hive 自定义资源。

按照 集群池文档,使用 Hive ClusterPool API 创建集群。

1.7.3.2. 在集群创建过程中配置额外清单

您可以在创建集群的过程中配置额外的 Kubernetes 资源清单。如果您需要为配置网络或设置负载均衡器等场景配置额外清单,这可以提供帮助。

1.7.3.2.1. 先决条件

添加对 ClusterDeployment 资源的引用,该资源指定包含其他资源清单的配置映射资源。

注: ClusterDeployment 资源和配置映射必须位于同一命名空间中。

1.7.3.2.2. 使用示例在集群创建过程中配置额外清单

如果要使用带有资源清单的配置映射配置其他清单,请完成以下步骤:

创建 YAML 文件并添加以下示例内容:

kind: ConfigMap apiVersion: v1 metadata: name: <my-baremetal-cluster-install-manifests> namespace: <mynamespace> data: 99_metal3-config.yaml: | kind: ConfigMap apiVersion: v1 metadata: name: metal3-config namespace: openshift-machine-api data: http_port: "6180" provisioning_interface: "enp1s0" provisioning_ip: "172.00.0.3/24" dhcp_range: "172.00.0.10,172.00.0.100" deploy_kernel_url: "http://172.00.0.3:6180/images/ironic-python-agent.kernel" deploy_ramdisk_url: "http://172.00.0.3:6180/images/ironic-python-agent.initramfs" ironic_endpoint: "http://172.00.0.3:6385/v1/" ironic_inspector_endpoint: "http://172.00.0.3:5150/v1/" cache_url: "http://192.168.111.1/images" rhcos_image_url: "https://releases-art-rhcos.svc.ci.openshift.org/art/storage/releases/rhcos-4.3/43.81.201911192044.0/x86_64/rhcos-43.81.201911192044.0-openstack.x86_64.qcow2.gz"注: 示例

ConfigMap包含带有另一个ConfigMap资源的清单。资源清单ConfigMap可以包含多个键,并在以下模式中添加资源配置data.<resource_name>\.yaml。运行以下命令来应用该文件:

oc apply -f <filename>.yaml如果要使用

ClusterDeployment通过引用资源清单ConfigMap配置其他清单,请完成以下步骤:创建 YAML 文件并添加以下示例内容。资源清单

ConfigMap在spec.provisioning.manifestsConfigMapRef中引用:apiVersion: hive.openshift.io/v1 kind: ClusterDeployment metadata: name: <my-baremetal-cluster> namespace: <mynamespace> annotations: hive.openshift.io/try-install-once: "true" spec: baseDomain: test.example.com clusterName: <my-baremetal-cluster> controlPlaneConfig: servingCertificates: {} platform: baremetal: libvirtSSHPrivateKeySecretRef: name: provisioning-host-ssh-private-key provisioning: installConfigSecretRef: name: <my-baremetal-cluster-install-config> sshPrivateKeySecretRef: name: <my-baremetal-hosts-ssh-private-key> manifestsConfigMapRef: name: <my-baremetal-cluster-install-manifests> imageSetRef: name: <my-clusterimageset> sshKnownHosts: - "10.1.8.90 ecdsa-sha2-nistp256 AAAAE2VjZHNhLXvVVVKUYVkuyvkuygkuyTCYTytfkufTYAAAAIbmlzdHAyNTYAAABBBKWjJRzeUVuZs4yxSy4eu45xiANFIIbwE3e1aPzGD58x/NX7Yf+S8eFKq4RrsfSaK2hVJyJjvVIhUsU9z2sBJP8=" pullSecretRef: name: <my-baremetal-cluster-pull-secret>运行以下命令来应用该文件:

oc apply -f <filename>.yaml

1.7.3.3. 在 Amazon Web Services 上创建集群

您可以使用 multicluster engine operator 控制台在 Amazon Web Services (AWS)上创建 Red Hat OpenShift Container Platform 集群。

在创建集群时,创建过程使用 Hive 资源中的 OpenShift Container Platform 安装程序。如果在完成此步骤后集群创建有疑问,请参阅 OpenShift Container Platform 文档中的在 AWS 上安装 有关流程的更多信息。

1.7.3.3.1. 先决条件

在 AWS 上创建集群前请查看以下先决条件:

- 您必须已部署 hub 集群。

- 您需要 AWS 凭证。如需更多信息,请参阅为 Amazon Web Services 创建凭证。

- 您在 AWS 中需要配置的域。有关如何配置域的说明,请参阅配置 AWS 帐户。

- 您需要具有 Amazon Web Services (AWS) 登录凭证,其中包括用户名、密码、访问密钥 ID 和 secret 访问密钥。请参阅了解和获取您的安全凭证。

您必须具有 OpenShift Container Platform 镜像 pull secret。请参阅使用镜像 pull secret。

注: 如果您在云供应商中更改云供应商访问密钥,您还需要在控制台中手动更新与云供应商对应的凭证。当凭证在托管受管集群的云供应商过期并尝试删除受管集群时,需要此项。

1.7.3.3.2. 创建 AWS 集群

请参阅以下有关创建 AWS 集群的重要信息:

-

当您在创建集群前查看信息并选择性地自定义它时,您可以选择 YAML: On 查看面板中的

install-config.yaml文件内容。如果有更新,您可以使用自定义设置编辑 YAML 文件。 - 在创建集群时,控制器会为集群和资源创建一个命名空间。确保只在该命名空间中包含该集群实例的资源。

- 销毁集群 会删除命名空间和所有资源。

-

如果要将集群添加到现有的集群集中,则需要在集群设置上具有正确的权限来添加它。如果在创建集群时没有

cluster-admin权限,则必须选择一个具有clusterset-admin权限的集群集。 -

如果您在指定的集群集中没有正确的权限,集群创建会失败。如果您没有任何集群集选项,请联络您的集群管理员,为集群集提供

clusterset-admin权限。 -

每个受管集群都必须与受管集群集关联。如果您没有将受管集群分配给

ManagedClusterSet,则会自动添加到default受管集群集中。 - 如果已有与您使用 AWS 帐户配置的所选凭证关联的基本 DNS 域,则该值会在字段中填充。您可以修改它的值来覆盖它。此名称用于集群的主机名。

- 发行镜像标识用于创建集群的 OpenShift Container Platform 镜像的版本。从可用的镜像列表中选择镜像。如果要使用的镜像不可用,您可以输入您要使用的镜像的 URL。

节点池包括 control plane 池和 worker 池。control plane 节点共享集群活动的管理。该信息包括以下字段:

- region:指定您要节点池的区域。

- CPU 架构:如果受管集群的架构类型与 hub 集群的架构不同,请为池中机器的说明集合架构输入一个值。有效值为 amd64, ppc64le, s390x, 和 arm64。

- Zones:指定您要运行 control plane 池的位置。您可以为更分布式的 control plane 节点选择区域中的多个区。距离更近的区域可能会提供更快的性能,但距离更远的区域可能更为分散。

- 实例类型:指定 control plane 节点的实例类型。您可以在实例创建后更改实例的类型和大小。

- 根存储:指定要为集群分配的 root 存储量。

您可以在 worker 池中创建零个或多个 worker 节点,以运行集群的容器工作负载。这可以位于单个 worker 池中,也可以分布到多个 worker 池中。如果指定了零个 worker 节点,control plane 节点也充当 worker 节点。可选信息包括以下字段:

- Zones:指定您要运行 worker 池的位置。您可以为更加分散的节点组群选择区域中的多个区。距离更近的区域可能会提供更快的性能,但距离更远的区域可能更为分散。

- 实例类型:指定 worker 池的实例类型。您可以在实例创建后更改实例的类型和大小。

- 节点数:指定 worker 池的节点计数。定义 worker 池时需要此设置。

- 根存储:指定分配给 worker 池的根存储量。定义 worker 池时需要此设置。

- 集群需要网络详情,并使用 IPv6 需要多个网络。您可以通过点 Add network 来添加额外网络。

凭证中提供的代理信息会自动添加到代理字段中。您可以使用信息原样,覆盖这些信息,或者在要启用代理时添加信息。以下列表包含创建代理所需的信息:

-

HTTP 代理:指定应用作

HTTP流量的代理的 URL。 -

HTTPS 代理:指定用于

HTTPS流量的安全代理 URL。如果没有提供值,则使用相同的值HTTP Proxy URL,用于HTTP和HTTPS。 -

没有代理站点:一个以逗号分隔的站点列表,用于绕过代理。使用一个句点 (

.) 开始的域名,包含该域中的所有子域。添加一个星号*以绕过所有目的地的代理。 - 其他信任捆绑包:代理 HTTPS 连接所需的一个或多个额外 CA 证书。

-

HTTP 代理:指定应用作

1.7.3.3.3. 使用控制台创建集群

要创建新集群,请参阅以下流程。如果您有一个要导入的现有集群,请参阅集群 导入。

注: 您不必运行 oc 命令,它为导入集群提供集群详情。创建集群时,它由 multicluster engine operator 管理自动配置。

- 进入 Infrastructure > Clusters。

- 在 Clusters 页面上。点 Cluster > Create cluster 并完成控制台中的步骤。

- 可选: 在控制台中输入信息时,选择 YAML: On 查看内容更新。

如果您需要创建凭证,请参阅为 Amazon Web Services 创建凭证。

集群的主机名用于集群的主机名。

如果您使用 Red Hat Advanced Cluster Management for Kubernetes,并希望将受管集群 klusterlet 配置为在特定节点上运行,请参阅 可选:配置 klusterlet 以在特定节点上运行 所需步骤。

1.7.3.3.4. 其他资源

- 在创建 AWS GovCloud 集群时使用 AWS 私有配置信息。有关 在该环境中创建集群的信息,请参阅在 Amazon Web Services GovCloud 上创建集群。

- 如需更多信息 ,请参阅配置 AWS 帐户。

- 有关发行镜像的更多信息,请参阅发行镜像。

- 通过访问您的云供应商站点(如 AWS 通用目的实例),找到有关支持的即时类型的更多信息。

1.7.3.4. 在 Amazon Web Services GovCloud 上创建集群

您可以使用控制台在 Amazon Web Services (AWS)或 AWS GovCloud 上创建 Red Hat OpenShift Container Platform 集群。此流程解释了如何在 AWS GovCloud 上创建集群。有关在 AWS 上创建集群的说明,请参阅在 Amazon Web Services 上创建集群。

AWS GovCloud 提供满足在云上存储政府文档所需的额外要求。在 AWS GovCloud 上创建集群时,您必须完成额外的步骤来准备您的环境。

在创建集群时,创建过程使用 Hive 资源中的 OpenShift Container Platform 安装程序。如果在完成此步骤后集群创建有疑问,请参阅 OpenShift Container Platform 文档中的在 AWS 上安装集群到一个政府区域。以下小节提供了在 AWS GovCloud 上创建集群的步骤:

1.7.3.4.1. 先决条件

创建 AWS GovCloud 集群前必须满足以下先决条件:

- 您必须具有 AWS 登录凭证,其中包括用户名、密码、访问密钥 ID 和 secret 访问密钥。请参阅了解和获取您的安全凭证。

- 您需要 AWS 凭证。如需更多信息,请参阅为 Amazon Web Services 创建凭证。

- 您在 AWS 中需要配置的域。有关如何配置域的说明,请参阅配置 AWS 帐户。

- 您必须具有 OpenShift Container Platform 镜像 pull secret。请参阅使用镜像 pull secret。

- 您必须具有带有 hub 集群的现有 Red Hat OpenShift Container Platform 集群的 Amazon Virtual Private Cloud (VPC)。此 VPC 必须与用于受管集群资源或受管集群的服务端点的 VPC 不同。

- 您需要部署受管集群资源的 VPC。这不能与用于 hub 集群或受管集群的服务端点的 VPC 相同。

- 您需要一个或多个提供受管集群服务端点的 VPC。这不能与用于 hub 集群或受管集群的 VPC 相同。

- 确保由无类别域间路由(CIDR)指定的 VPC 的 IP 地址不会重叠。

-

您需要一个

HiveConfig自定义资源来引用 Hive 命名空间中的凭证。此自定义资源必须有权访问为受管集群服务端点创建的 VPC 上创建资源。

注: 如果您在云供应商中更改了云供应商访问密钥,则需要在 multicluster engine operator 控制台中手动更新云供应商的对应凭证。当凭证在托管受管集群的云供应商过期并尝试删除受管集群时,需要此项。

1.7.3.4.2. 配置 Hive 以在 AWS GovCloud 上部署

虽然在 AWS GovCloud 上创建集群时与在标准 AWS 上创建集群几乎相同,但您必须完成一些额外的步骤,以便在 AWS GovCloud 上为集群准备 AWS PrivateLink。

1.7.3.4.2.1. 为资源和端点创建 VPC

如先决条件中所示,除了包含 hub 集群的 VPC 外,还需要两个 VPC。有关创建 VPC 的具体步骤,请参阅 Amazon Web Services 文档中的创建 VPC。

- 使用专用子网为受管集群创建 VPC。

- 使用专用子网为受管集群服务端点创建一个或多个 VPC。区域中的每个 VPC 的限制是 255 VPC 端点,因此您需要多个 VPC 来支持该区域中的 255 多个集群。

对于每个 VPC,在区域的所有支持的可用区中创建子网。由于控制器要求,每个子网必须至少有 255 个可用的 IP 地址。

以下示例演示了如何在

us-gov-east-1区域中存在 6 个可用区的 VPC 结构子网:vpc-1 (us-gov-east-1) : 10.0.0.0/20 subnet-11 (us-gov-east-1a): 10.0.0.0/23 subnet-12 (us-gov-east-1b): 10.0.2.0/23 subnet-13 (us-gov-east-1c): 10.0.4.0/23 subnet-12 (us-gov-east-1d): 10.0.8.0/23 subnet-12 (us-gov-east-1e): 10.0.10.0/23 subnet-12 (us-gov-east-1f): 10.0.12.0/2vpc-2 (us-gov-east-1) : 10.0.16.0/20 subnet-21 (us-gov-east-1a): 10.0.16.0/23 subnet-22 (us-gov-east-1b): 10.0.18.0/23 subnet-23 (us-gov-east-1c): 10.0.20.0/23 subnet-24 (us-gov-east-1d): 10.0.22.0/23 subnet-25 (us-gov-east-1e): 10.0.24.0/23 subnet-26 (us-gov-east-1f): 10.0.28.0/23- 确保所有 hub 环境(hub 集群 VPC)都与您为使用 peering、传输网关和所有 DNS 设置的 VPC 创建的 VPC 有网络连接。

- 收集解析 AWS PrivateLink 的 DNS 设置所需的 VPC 列表,这是 AWS GovCloud 连接所必需的。这至少包括您要配置的多集群引擎 operator 实例的 VPC,可以包含存在各种 Hive 控制器的所有 VPC 列表。

1.7.3.4.2.2. 为 VPC 端点配置安全组

AWS 中的每个 VPC 端点都附加了一个安全组,用于控制对端点的访问。当 Hive 创建 VPC 端点时,它不会指定安全组。VPC 的默认安全组附加到 VPC 端点。VPC 的默认安全组必须具有规则来允许从 Hive 安装程序 pod 创建 VPC 端点的流量。详情请参阅 AWS 文档中的使用端点策略控制对 VPC 端点的访问。

例如,如果 Hive 在 hive-vpc (10.1.0.0/16) 中运行,则必须在 VPC 的默认安全组中有一个规则,其中创建 VPC 端点,允许从 ingress 10.1.0.0/16。

1.7.3.4.2.3. 为 AWS PrivateLink 设置权限

您需要多个凭证来配置 AWS PrivateLink。这些凭证所需的权限取决于凭证类型。

ClusterDeployment 的凭证需要以下权限:

ec2:CreateVpcEndpointServiceConfiguration ec2:DescribeVpcEndpointServiceConfigurations ec2:ModifyVpcEndpointServiceConfiguration ec2:DescribeVpcEndpointServicePermissions ec2:ModifyVpcEndpointServicePermissions ec2:DeleteVpcEndpointServiceConfigurations端点 VPCs 帐户

.spec.awsPrivateLink.credentialsSecretRef的凭证需要以下权限:ec2:DescribeVpcEndpointServices ec2:DescribeVpcEndpoints ec2:CreateVpcEndpoint ec2:CreateTags ec2:DescribeNetworkInterfaces ec2:DescribeVPCs ec2:DeleteVpcEndpoints route53:CreateHostedZone route53:GetHostedZone route53:ListHostedZonesByVPC route53:AssociateVPCWithHostedZone route53:DisassociateVPCFromHostedZone route53:CreateVPCAssociationAuthorization route53:DeleteVPCAssociationAuthorization route53:ListResourceRecordSets route53:ChangeResourceRecordSets route53:DeleteHostedZoneHiveConfig自定义资源中指定的凭证,用于将 VPC 与私有托管区(.spec.awsPrivateLink.associatedVPCs[$idx].credentialsSecretRef)关联。VPC 所在的帐户需要以下权限:route53:AssociateVPCWithHostedZone route53:DisassociateVPCFromHostedZone ec2:DescribeVPCs

确保 hub 集群上的 Hive 命名空间中有一个凭证 secret。

HiveConfig 自定义资源需要引用 Hive 命名空间中的凭证,该凭证有权在特定提供的 VPC 中创建资源。如果您要在 AWS GovCloud 中置备 AWS 集群的凭证已在 Hive 命名空间中,则不需要创建另一个集群。如果您在 AWS GovCloud 中置备 AWS 集群的凭证还没有在 Hive 命名空间中,您可以替换您当前的凭证,或者在 Hive 命名空间中创建额外的凭证。

HiveConfig 自定义资源需要包含以下内容:

- 具有为给定 VPC 置备资源所需的权限的 AWS GovCloud 凭证。

OpenShift Container Platform 集群安装的 VPC 地址,以及受管集群的服务端点。

最佳实践: 将不同的 VPC 用于 OpenShift Container Platform 集群安装和服务端点。

以下示例显示了凭证内容:

spec:

awsPrivateLink:

## The list of inventory of VPCs that can be used to create VPC

## endpoints by the controller.

endpointVPCInventory:

- region: us-east-1

vpcID: vpc-1

subnets:

- availabilityZone: us-east-1a

subnetID: subnet-11

- availabilityZone: us-east-1b

subnetID: subnet-12

- availabilityZone: us-east-1c

subnetID: subnet-13

- availabilityZone: us-east-1d

subnetID: subnet-14

- availabilityZone: us-east-1e

subnetID: subnet-15

- availabilityZone: us-east-1f

subnetID: subnet-16

- region: us-east-1

vpcID: vpc-2

subnets:

- availabilityZone: us-east-1a

subnetID: subnet-21

- availabilityZone: us-east-1b

subnetID: subnet-22

- availabilityZone: us-east-1c

subnetID: subnet-23

- availabilityZone: us-east-1d

subnetID: subnet-24

- availabilityZone: us-east-1e

subnetID: subnet-25

- availabilityZone: us-east-1f

subnetID: subnet-26

## The credentialsSecretRef references a secret with permissions to create.

## The resources in the account where the inventory of VPCs exist.

credentialsSecretRef:

name: <hub-account-credentials-secret-name>

## A list of VPC where various mce clusters exists.

associatedVPCs:

- region: region-mce1

vpcID: vpc-mce1

credentialsSecretRef:

name: <credentials-that-have-access-to-account-where-MCE1-VPC-exists>

- region: region-mce2

vpcID: vpc-mce2

credentialsSecretRef:

name: <credentials-that-have-access-to-account-where-MCE2-VPC-exists>

您可以从 endpointVPCInventory 列表中支持 AWS PrivateLink 的所有区域包含一个 VPC。控制器选择一个 VPC,它满足 ClusterDeployment 的要求。

如需更多信息,请参阅 Hive 文档。

1.7.3.4.3. 使用控制台创建集群

要从控制台创建集群,请导航到 Infrastructure > Clusters > Create cluster AWS > Standalone 并完成控制台中的步骤。

注: 此过程用于创建集群。如果您有一个要导入的现有集群,请参阅 集群导入。

如果创建了 AWS GovCloud 集群,则您选择的凭证必须有权访问 AWS GovCloud 区域中的资源。如果您有部署集群所需的权限,您可以使用 Hive 命名空间中已存在的 AWS GovCloud secret。控制台中会显示现有凭证。如果您需要创建凭证,请参阅为 Amazon Web Services 创建凭证。

集群的主机名用于集群的主机名。

重要: 当您创建集群时,控制器会为集群及其资源创建一个命名空间。确保只在该命名空间中包含该集群实例的资源。销毁集群会删除命名空间和所有资源。

提示: 在控制台中输入信息时,选择 YAML: On 查看内容更新。

如果要将集群添加到现有的集群集中,则需要在集群设置上具有正确的权限来添加它。如果在创建集群时没有 cluster-admin 权限,则必须选择一个具有 clusterset-admin 权限的集群集。如果您在指定的集群集中没有正确的权限,集群创建会失败。如果您没有任何集群集选项,请联络您的集群管理员,为集群集提供 clusterset-admin 权限。

每个受管集群都必须与受管集群集关联。如果您没有将受管集群分配给 ManagedClusterSet,则会自动添加到 default 受管集群集中。

如果已有与您使用 AWS 或 AWS GovCloud 帐户配置的所选凭证关联的基本 DNS 域,则该值会在字段中填充。您可以修改它的值来覆盖它。此名称用于集群的主机名。如需更多信息 ,请参阅配置 AWS 帐户。

发行镜像标识用于创建集群的 OpenShift Container Platform 镜像的版本。如果要使用的版本可用,您可以从镜像列表中选择镜像。如果您要使用的镜像不是标准镜像,您可以输入您要使用的镜像的 URL。有关发行镜像的更多信息,请参阅发行镜像。

节点池包括 control plane 池和 worker 池。control plane 节点共享集群活动的管理。该信息包括以下字段:

-

Region :创建集群资源的区域。如果要在 AWS GovCloud 供应商中创建集群,您必须为节点池包含 AWS GovCloud 区域。例如,

us-gov-west-1。 - CPU 架构:如果受管集群的架构类型与 hub 集群的架构不同,请为池中机器的说明集合架构输入一个值。有效值为 amd64, ppc64le, s390x, 和 arm64。

- Zones:指定您要运行 control plane 池的位置。您可以为更分布式的 control plane 节点选择区域中的多个区。距离更近的区域可能会提供更快的性能,但距离更远的区域可能更为分散。

- 实例类型:为您的 control plane 节点指定实例类型,它必须与之前所示的 CPU 架构 相同。您可以在实例创建后更改实例的类型和大小。

- 根存储:指定要为集群分配的 root 存储量。

您可以在 worker 池中创建零个或多个 worker 节点,以运行集群的容器工作负载。它们可以位于单个 worker 池中,也可以分布在多个 worker 池中。如果指定了零个 worker 节点,control plane 节点也充当 worker 节点。可选信息包括以下字段:

- 池名称 :为您的池提供唯一名称。

- Zones:指定您要运行 worker 池的位置。您可以为更加分散的节点组群选择区域中的多个区。距离更近的区域可能会提供更快的性能,但距离更远的区域可能更为分散。

- 实例类型:指定 worker 池的实例类型。您可以在实例创建后更改实例的类型和大小。

- 节点数:指定 worker 池的节点计数。定义 worker 池时需要此设置。

- 根存储:指定分配给 worker 池的根存储量。定义 worker 池时需要此设置。

集群需要网络详情,并使用 IPv6 需要多个网络。对于 AWS GovCloud 集群,在 Machine CIDR 字段中输入 Hive VPC 的地址块的值。您可以通过点 Add network 来添加额外网络。

凭证中提供的代理信息会自动添加到代理字段中。您可以使用信息原样,覆盖这些信息,或者在要启用代理时添加信息。以下列表包含创建代理所需的信息:

-

HTTP 代理 URL:指定应当用作

HTTP流量的代理的 URL。 -

HTTPS 代理 URL:指定用于

HTTPS流量的安全代理 URL。如果没有提供值,则使用相同的值HTTP Proxy URL,用于HTTP和HTTPS。 -

无代理域:应当绕过代理的以逗号分隔的域列表。使用一个句点 (

.) 开始的域名,包含该域中的所有子域。添加一个星号*以绕过所有目的地的代理。 - 其他信任捆绑包:代理 HTTPS 连接所需的一个或多个额外 CA 证书。

在创建 AWS GovCloud 集群或使用私有环境时,使用 AMI ID 和子网值完成 AWS 私有配置页面 中的字段。在 ClusterDeployment.yaml 文件中,确保将 spec:platform:aws:privateLink:enabled 的值设置为 true,该文件在选择 Use private configuration 时会自动设置。

当您在创建集群前查看信息并选择性地自定义它时,您可以选择 YAML: On 查看面板中的 install-config.yaml 文件内容。如果有更新,您可以使用自定义设置编辑 YAML 文件。

注: 您不必运行 oc 命令,它为导入集群提供集群详情。创建集群时,它由 multicluster engine for Kubernetes operator 管理自动配置。

如果您使用 Red Hat Advanced Cluster Management for Kubernetes,并希望将受管集群 klusterlet 配置为在特定节点上运行,请参阅 可选:配置 klusterlet 以在特定节点上运行 所需步骤。

如需了解更多与访问集群相关的信息,继续访问集群。

1.7.3.5. 在 Microsoft Azure 上创建集群

您可以使用 multicluster engine operator 控制台在 Microsoft Azure 或 Microsoft Azure Government 上部署 Red Hat OpenShift Container Platform 集群。

在创建集群时,创建过程使用 Hive 资源中的 OpenShift Container Platform 安装程序。如果在完成此步骤后集群创建有疑问,请参阅 OpenShift Container Platform 文档中的在 Azure 上安装 有关流程的更多信息。

1.7.3.5.1. 先决条件

在 Azure 上创建集群前请查看以下先决条件:

- 您必须已部署 hub 集群。

- 您需要一个 Azure 凭证。如需更多信息,请参阅为 Microsoft Azure 创建凭证。

- 您需要在 Azure 或 Azure Government 中配置了域。有关如何配置域的说明,请参阅为 Azure 云服务配置自定义域名。

- 您需要 Azure 登录凭证,其中包括用户名和密码。请参阅 Microsoft Azure Portal。

-

您需要 Azure 服务主体,其中包括

clientId、clientSecret和tenantId。请参阅 azure.microsoft.com。 - 您需要 OpenShift Container Platform 镜像 pull secret。请参阅使用镜像 pull secret。

注: 如果您在云供应商中更改了云供应商访问密钥,则需要在 multicluster engine operator 的控制台中手动更新云供应商对应的凭证。当凭证在托管受管集群的云供应商过期并尝试删除受管集群时,需要此项。

1.7.3.5.2. 使用控制台创建集群

要从多集群引擎 operator 控制台创建集群,请导航到 Infrastructure > Clusters。在 Clusters 页面上,点 Create cluster 并完成控制台中的步骤。

注: 此过程用于创建集群。如果您有一个要导入的现有集群,请参阅 集群导入。

如果您需要创建凭证,请参阅为 Microsoft Azure 创建凭证。

集群的主机名用于集群的主机名。

重要: 当您创建集群时,控制器会为集群及其资源创建一个命名空间。确保只在该命名空间中包含该集群实例的资源。销毁集群会删除命名空间和所有资源。

提示: 在控制台中输入信息时,选择 YAML: On 查看内容更新。

如果要将集群添加到现有的集群集中,则需要在集群设置上具有正确的权限来添加它。如果在创建集群时没有 cluster-admin 权限,则必须选择一个具有 clusterset-admin 权限的集群集。如果您在指定的集群集中没有正确的权限,集群创建会失败。如果您没有任何集群集选项,请联络您的集群管理员,为集群集提供 clusterset-admin 权限。

每个受管集群都必须与受管集群集关联。如果您没有将受管集群分配给 ManagedClusterSet,则会自动添加到 default 受管集群集中。

如果已有与您为 Azure 帐户配置的所选凭证关联的基本 DNS 域,则该值会在那个字段中填充。您可以修改它的值来覆盖它。如需更多信息,请参阅为 Azure 云服务配置自定义域名。此名称用于集群的主机名。

发行镜像标识用于创建集群的 OpenShift Container Platform 镜像的版本。如果要使用的版本可用,您可以从镜像列表中选择镜像。如果您要使用的镜像不是标准镜像,您可以输入您要使用的镜像的 URL。有关发行镜像的更多信息,请参阅发行镜像。

Node 池包括 control plane 池和 worker 池。control plane 节点共享集群活动的管理。该信息包括以下可选字段:

- region:指定一个您要运行节点池的区域。您可以为更分布式的 control plane 节点选择区域中的多个区。距离更近的区域可能会提供更快的性能,但距离更远的区域可能更为分散。

- CPU 架构:如果受管集群的架构类型与 hub 集群的架构不同,请为池中机器的说明集合架构输入一个值。有效值为 amd64, ppc64le, s390x, 和 arm64。

您可以在创建集群后更改 control plane 池的实例类型和 Root 存储分配(必需)的类型和大小。

您可以在 worker 池中创建一个或多个 worker 节点,以运行集群的容器工作负载。它们可以位于单个 worker 池中,也可以分布在多个 worker 池中。如果指定了零个 worker 节点,control plane 节点也充当 worker 节点。该信息包括以下字段:

- Zones:指定您要运行 worker 池的位置。您可以为更加分散的节点组群选择区域中的多个区。距离更近的区域可能会提供更快的性能,但距离更远的区域可能更为分散。

- 实例类型:您可以在实例创建后更改实例的类型和大小。

您可以通过点 Add network 来添加额外网络。如果您使用的是 IPv6 地址,您必须有多个网络。

凭证中提供的代理信息会自动添加到代理字段中。您可以使用信息原样,覆盖这些信息,或者在要启用代理时添加信息。以下列表包含创建代理所需的信息:

-

HTTP 代理:用作

HTTP流量的代理的 URL。 -

HTTPS 代理 :用于

HTTPS流量的安全代理 URL。如果没有提供值,则使用相同的值HTTP Proxy URL,用于HTTP和HTTPS。 -

无代理:应绕过代理的域列表。使用一个句点 (

.) 开始的域名,包含该域中的所有子域。添加一个星号*以绕过所有目的地的代理。 - 其他信任捆绑包:代理 HTTPS 连接所需的一个或多个额外 CA 证书。

当您在创建集群前查看信息并选择性地自定义它时,您可以点 YAML 切换 On 查看面板中的 install-config.yaml 文件内容。如果有更新,您可以使用自定义设置编辑 YAML 文件。

如果您使用 Red Hat Advanced Cluster Management for Kubernetes,并希望将受管集群 klusterlet 配置为在特定节点上运行,请参阅 可选:配置 klusterlet 以在特定节点上运行 所需步骤。

注: 您不必运行 oc 命令,它为导入集群提供集群详情。创建集群时,它由 multicluster engine operator 管理自动配置。

如需了解更多与访问集群相关的信息,继续访问集群。

1.7.3.6. 在 Google Cloud Platform 上创建集群

按照步骤在 Google Cloud Platform (GCP) 上创建 Red Hat OpenShift Container Platform 集群有关 GCP 的更多信息,请参阅 Google Cloud Platform。

在创建集群时,创建过程使用 Hive 资源中的 OpenShift Container Platform 安装程序。如果在完成此步骤后集群创建有疑问,请参阅 OpenShift Container Platform 文档中的在 GCP 上安装 有关流程的更多信息。

1.7.3.6.1. 先决条件

在 GCP 上创建集群前请查看以下先决条件:

- 您必须已部署 hub 集群。

- 您必须具有 GCP 凭证。如需更多信息,请参阅为 Google Cloud Platform 创建凭证。

- 您必须在 GCP 中配置了域。有关如何配置域的说明,请参阅设置自定义域。

- 您需要 GCP 登录凭证,其中包括用户名和密码。

- 您必须具有 OpenShift Container Platform 镜像 pull secret。请参阅使用镜像 pull secret。

注: 如果您在云供应商中更改了云供应商访问密钥,则需要在 multicluster engine operator 的控制台中手动更新云供应商对应的凭证。当凭证在托管受管集群的云供应商过期并尝试删除受管集群时,需要此项。

1.7.3.6.2. 使用控制台创建集群

要从多集群引擎 operator 控制台创建集群,请导航到 Infrastructure > Clusters。在 Clusters 页面上,点 Create cluster 并完成控制台中的步骤。

注: 此过程用于创建集群。如果您有一个要导入的现有集群,请参阅 集群导入。

如果您需要创建凭证,请参阅为 Google Cloud Platform 创建凭证。

集群名称用于集群的主机名。在命名 GCP 集群时有一些限制。这些限制包括,名称不要以 goog 开始;名称的任何部分都不要包含与 google 类似的内容。如需了解完整的限制列表,请参阅 Bucket 命名指南。

重要: 当您创建集群时,控制器会为集群及其资源创建一个命名空间。确保只在该命名空间中包含该集群实例的资源。销毁集群会删除命名空间和所有资源。

提示: 在控制台中输入信息时,选择 YAML: On 查看内容更新。

如果要将集群添加到现有的集群集中,则需要在集群设置上具有正确的权限来添加它。如果在创建集群时没有 cluster-admin 权限,则必须选择一个具有 clusterset-admin 权限的集群集。如果您在指定的集群集中没有正确的权限,集群创建会失败。如果您没有任何集群集选项,请联络您的集群管理员,为集群集提供 clusterset-admin 权限。

每个受管集群都必须与受管集群集关联。如果您没有将受管集群分配给 ManagedClusterSet,则会自动添加到 default 受管集群集中。

如果已有与 GCP 帐户所选凭证关联的基本 DNS 域,则该值会在字段中填充。您可以修改它的值来覆盖它。如需更多信息,请参阅设置自定义域。此名称用于集群的主机名。

发行镜像标识用于创建集群的 OpenShift Container Platform 镜像的版本。如果要使用的版本可用,您可以从镜像列表中选择镜像。如果您要使用的镜像不是标准镜像,您可以输入您要使用的镜像的 URL。有关发行镜像的更多信息,请参阅发行镜像。

Node 池包括 control plane 池和 worker 池。control plane 节点共享集群活动的管理。该信息包括以下字段:

- Region:指定您要运行 control plane 池的区域。距离更近的区域可能会提供更快的性能,但距离更远的区域可能更为分散。

- CPU 架构:如果受管集群的架构类型与 hub 集群的架构不同,请为池中机器的说明集合架构输入一个值。有效值为 amd64, ppc64le, s390x, 和 arm64。

您可以指定 control plane 池的实例类型。您可以在实例创建后更改实例的类型和大小。

您可以在 worker 池中创建一个或多个 worker 节点,以运行集群的容器工作负载。它们可以位于单个 worker 池中,也可以分布在多个 worker 池中。如果指定了零个 worker 节点,control plane 节点也充当 worker 节点。该信息包括以下字段:

- 实例类型:您可以在实例创建后更改实例的类型和大小。

- 节点数:定义 worker 池时需要此设置。

网络详细信息是必需的,需要使用 IPv6 地址的多个网络。您可以通过点 Add network 来添加额外网络。

凭证中提供的代理信息会自动添加到代理字段中。您可以使用信息原样,覆盖这些信息,或者在要启用代理时添加信息。以下列表包含创建代理所需的信息:

-

HTTP 代理:用作

HTTP流量的代理的 URL。 -

HTTPS 代理 :用于

HTTPS流量的安全代理 URL。如果没有提供值,则使用相同的值HTTP Proxy URL,用于HTTP和HTTPS。 -

没有代理站点:一个以逗号分隔的站点列表,用于绕过代理。使用一个句点 (

.) 开始的域名,包含该域中的所有子域。添加一个星号*以绕过所有目的地的代理。 - 其他信任捆绑包:代理 HTTPS 连接所需的一个或多个额外 CA 证书。

当您在创建集群前查看信息并选择性地自定义它时,您可以选择 YAML: On 查看面板中的 install-config.yaml 文件内容。如果有更新,您可以使用自定义设置编辑 YAML 文件。

如果您使用 Red Hat Advanced Cluster Management for Kubernetes,并希望将受管集群 klusterlet 配置为在特定节点上运行,请参阅 可选:配置 klusterlet 以在特定节点上运行 所需步骤。

注: 您不必运行 oc 命令,它为导入集群提供集群详情。创建集群时,它由 multicluster engine operator 管理自动配置。

如需了解更多与访问集群相关的信息,继续访问集群。

1.7.3.7. 在 VMware vSphere 上创建集群

您可以使用 multicluster engine operator 控制台在 VMware vSphere 上部署 Red Hat OpenShift Container Platform 集群。

在创建集群时,创建过程使用 Hive 资源中的 OpenShift Container Platform 安装程序。如果在完成此步骤后集群创建有疑问,请参阅 OpenShift Container Platform 文档中的在 vSphere 上安装 有关流程的更多信息。

1.7.3.7.1. 先决条件

在 vSphere 上创建集群前请查看以下先决条件:

- 您必须具有在一个受支持的 OpenShift Container Platform 版本上部署的 hub 集群。

- 您需要 vSphere 凭证。如需更多信息,请参阅为 VMware vSphere 创建凭证。

- 您需要 OpenShift Container Platform 镜像 pull secret。请参阅使用镜像 pull secret。

您必须具有要部署的 VMware 实例的以下信息:

- API 和 Ingress 实例所需的静态 IP 地址

以下的 DNS 记录:

以下 API 基域必须指向静态 API VIP:

api.<cluster_name>.<base_domain>以下应用程序基域必须指向 Ingress VIP 的静态 IP 地址:

*.apps.<cluster_name>.<base_domain>

1.7.3.7.2. 使用控制台创建集群

要从多集群引擎 operator 控制台创建集群,请导航到 Infrastructure > Clusters。在 Clusters 页面上,点 Create cluster 并完成控制台中的步骤。

注: 此过程用于创建集群。如果您有一个要导入的现有集群,请参阅 集群导入。

如果您需要创建凭证,请参阅为 VMware vSphere 创建凭证,以了解有关创建凭证的更多信息。

集群名称用于集群的主机名。

重要: 当您创建集群时,控制器会为集群及其资源创建一个命名空间。确保只在该命名空间中包含该集群实例的资源。销毁集群会删除命名空间和所有资源。

提示: 在控制台中输入信息时,选择 YAML: On 查看内容更新。

如果要将集群添加到现有的集群集中,则需要在集群设置上具有正确的权限来添加它。如果在创建集群时没有 cluster-admin 权限,则必须选择一个具有 clusterset-admin 权限的集群集。如果您在指定的集群集中没有正确的权限,集群创建会失败。如果您没有任何集群集选项,请联络您的集群管理员,为集群集提供 clusterset-admin 权限。

每个受管集群都必须与受管集群集关联。如果您没有将受管集群分配给 ManagedClusterSet,则会自动添加到 default 受管集群集中。

如果已有与您为 vSphere 帐户配置的所选凭证关联的基域,则该值会在字段中填充。您可以修改它的值来覆盖它。如需更多信息 ,请参阅使用自定义在 vSphere 上安装集群。这个值必须与创建 prerequisites 部分中列出的 DNS 记录的名称匹配。此名称用于集群的主机名。

发行镜像标识用于创建集群的 OpenShift Container Platform 镜像的版本。如果要使用的版本可用,您可以从镜像列表中选择镜像。如果您要使用的镜像不是标准镜像,您可以输入您要使用的镜像的 URL。有关发行镜像的更多信息,请参阅发行镜像。

注: 支持 OpenShift Container Platform 版本 4.15 及更新版本的发行镜像。

节点池包括 control plane 池和 worker 池。control plane 节点共享集群活动的管理。该信息包括 CPU 架构 字段。查看以下字段描述:

- CPU 架构:如果受管集群的架构类型与 hub 集群的架构不同,请为池中机器的说明集合架构输入一个值。有效值为 amd64, ppc64le, s390x, 和 arm64。

您可以在 worker 池中创建一个或多个 worker 节点,以运行集群的容器工作负载。它们可以位于单个 worker 池中,也可以分布在多个 worker 池中。如果指定了零个 worker 节点,control plane 节点也充当 worker 节点。信息包括 每个插槽的内核数、CPU、Memory_min MiB、_Disk 大小(以 GiB 为单位)和 节点数 。

需要网络信息。使用 IPv6 需要多个网络。一些所需网络信息包括以下字段:

- vSphere 网络名:指定 VMware vSphere 网络名称。

API VIP:指定用于内部 API 通信的 IP 地址。

注: 这个值必须与您用来创建 prerequisites 部分中列出的 DNS 记录的名称匹配。如果没有提供,DNS 必须预先配置,以便

api.可以正确解析。Ingress VIP:指定用于入口流量的 IP 地址。

注: 这个值必须与您用来创建 prerequisites 部分中列出的 DNS 记录的名称匹配。如果没有提供,则必须预先配置 DNS,以便

test.apps可以被正确解析。

您可以通过点 Add network 来添加额外网络。如果您使用的是 IPv6 地址,您必须有多个网络。

凭证中提供的代理信息会自动添加到代理字段中。您可以使用信息原样,覆盖这些信息,或者在要启用代理时添加信息。以下列表包含创建代理所需的信息:

-

HTTP 代理:指定应用作

HTTP流量的代理的 URL。 -

HTTPS 代理:指定用于

HTTPS流量的安全代理 URL。如果没有提供值,则使用相同的值HTTP Proxy URL,用于HTTP和HTTPS。 -

无代理站点:提供应绕过代理的站点的逗号分隔列表。使用一个句点 (

.) 开始的域名,包含该域中的所有子域。添加一个星号*以绕过所有目的地的代理。 - 其他信任捆绑包:代理 HTTPS 连接所需的一个或多个额外 CA 证书。

点 Disconnected installation 定义断开连接的安装。当使用 VMware vSphere 供应商和断开连接的安装创建集群时,如果需要一个证书才能访问镜像 registry,您必须在配置凭证时在 Configuration for disconnected installation 部分的 Additional trust bundle 字段中输入它,或者在创建集群时在 Disconnected installation 部分输入它。

您可以点击 Add Automation template 来创建模板。

当您在创建集群前查看信息并选择性地自定义它时,您可以点 YAML 切换 On 查看面板中的 install-config.yaml 文件内容。如果有更新,您可以使用自定义设置编辑 YAML 文件。

如果您使用 Red Hat Advanced Cluster Management for Kubernetes,并希望将受管集群 klusterlet 配置为在特定节点上运行,请参阅 可选:配置 klusterlet 以在特定节点上运行 所需步骤。

注: 您不必运行 oc 命令,它为导入集群提供集群详情。创建集群时,它由 multicluster engine operator 管理自动配置。

如需了解更多与访问集群相关的信息,继续访问集群。

1.7.3.8. 在 Red Hat OpenStack Platform 上创建集群

您可以使用 multicluster engine operator 控制台在 Red Hat OpenStack Platform 上部署 Red Hat OpenShift Container Platform 集群。

在创建集群时,创建过程使用 Hive 资源中的 OpenShift Container Platform 安装程序。如果在完成此步骤后集群创建有疑问,请参阅 OpenShift Container Platform 文档中的在 OpenStack 上安装 有关流程的更多信息。

1.7.3.8.1. 先决条件

在 Red Hat OpenStack Platform 上创建集群前请查看以下先决条件:

- 您必须在 OpenShift Container Platform 版本 4.6 或更高版本上部署了 hub 集群。

- 您必须具有 Red Hat OpenStack Platform 凭证。如需更多信息,请参阅为 Red Hat OpenStack Platform 创建凭证。

- 您需要 OpenShift Container Platform 镜像 pull secret。请参阅使用镜像 pull secret。

您要部署的 Red Hat OpenStack Platform 实例需要以下信息:

-

control plane 和 worker 实例的 flavor 名称,如

m1.xlarge - 外部网络的网络名称,以提供浮动 IP 地址

- API 和入口实例所需的浮动 IP 地址

以下的 DNS 记录:

以下 API 基域必须指向 API 的浮动 IP 地址:

api.<cluster_name>.<base_domain>以下应用程序基域必须指向 ingress:app-name 的浮动 IP 地址:

*.apps.<cluster_name>.<base_domain>

-

control plane 和 worker 实例的 flavor 名称,如

1.7.3.8.2. 使用控制台创建集群

要从多集群引擎 operator 控制台创建集群,请导航到 Infrastructure > Clusters。在 Clusters 页面上,点 Create cluster 并完成控制台中的步骤。

注: 此过程用于创建集群。如果您有一个要导入的现有集群,请参阅 集群导入。

如果需要创建凭证,请参阅为 Red Hat OpenStack Platform 创建凭证。

集群的主机名用于集群的主机名。名称必须包含少于 15 个字符。这个值必须与创建凭证先决条件中列出的 DNS 记录的名称匹配。

重要: 当您创建集群时,控制器会为集群及其资源创建一个命名空间。确保只在该命名空间中包含该集群实例的资源。销毁集群会删除命名空间和所有资源。

提示: 在控制台中输入信息时,选择 YAML: On 查看内容更新。

如果要将集群添加到现有的集群集中,则需要在集群设置上具有正确的权限来添加它。如果在创建集群时没有 cluster-admin 权限,则必须选择一个具有 clusterset-admin 权限的集群集。如果您在指定的集群集中没有正确的权限,集群创建会失败。如果您没有任何集群集选项,请联络您的集群管理员,为集群集提供 clusterset-admin 权限。

每个受管集群都必须与受管集群集关联。如果您没有将受管集群分配给 ManagedClusterSet,则会自动添加到 default 受管集群集中。

如果已有与您为 Red Hat OpenStack Platform 帐户配置的所选凭证关联的基本 DNS 域,则该值会在字段中填充。您可以修改它的值来覆盖它。如需更多信息,请参阅 Red Hat OpenStack Platform 文档中的管理域。此名称用于集群的主机名。

发行镜像标识用于创建集群的 OpenShift Container Platform 镜像的版本。如果要使用的版本可用,您可以从镜像列表中选择镜像。如果您要使用的镜像不是标准镜像,您可以输入您要使用的镜像的 URL。有关发行镜像的更多信息,请参阅发行镜像。仅支持 OpenShift Container Platform 版本 4.6.x 或更高版本的发行镜像。

节点池包括 control plane 池和 worker 池。control plane 节点共享集群活动的管理。如果受管集群的构架类型与 hub 集群的架构不同,请为池中机器的说明集合架构输入一个值。有效值为 amd64, ppc64le, s390x, 和 arm64。

您必须为 control plane 池添加实例类型,但您可以在实例创建后更改实例的类型和大小。

您可以在 worker 池中创建一个或多个 worker 节点,以运行集群的容器工作负载。它们可以位于单个 worker 池中,也可以分布在多个 worker 池中。如果指定了零个 worker 节点,control plane 节点也充当 worker 节点。该信息包括以下字段:

- 实例类型:您可以在实例创建后更改实例的类型和大小。

- 节点数:指定 worker 池的节点数。定义 worker 池时需要此设置。

集群需要网络详情。您必须为 IPv4 网络提供一个或多个网络的值。对于 IPv6 网络,您必须定义多个网络。

您可以通过点 Add network 来添加额外网络。如果您使用的是 IPv6 地址,您必须有多个网络。

凭证中提供的代理信息会自动添加到代理字段中。您可以使用信息原样,覆盖这些信息,或者在要启用代理时添加信息。以下列表包含创建代理所需的信息:

-

HTTP 代理:指定应用作

HTTP流量的代理的 URL。 -

HTTPS 代理 :用于

HTTPS流量的安全代理 URL。如果没有提供值,则使用与HTTP Proxy相同的值,用于HTTP和HTTPS。 -

No proxy :定义应绕过代理的站点列表。使用一个句点 (

.) 开始的域名,包含该域中的所有子域。添加一个星号*以绕过所有目的地的代理。 - 其他信任捆绑包:代理 HTTPS 连接所需的一个或多个额外 CA 证书。

您可以点 Disconnected 安装来定义断开连接的安装镜像。当使用 Red Hat OpenStack Platform 供应商和断开连接的安装创建集群时,如果需要一个证书才能访问镜像 registry,在配置集群时需要在 Configuration for disconnected installation 段中的 Additional trust bundle 字段中输入它,在创建集群时在 Disconnected installation 段中输入它。

当您在创建集群前查看信息并选择性地自定义它时,您可以点 YAML 切换 On 查看面板中的 install-config.yaml 文件内容。如果有更新,您可以使用自定义设置编辑 YAML 文件。

在创建使用内部证书颁发机构(CA)的集群时,您需要按照以下步骤自定义集群的 YAML 文件:

在 review 步骤中使用 YAML 切换,在列表的顶部插入带有 CA 证书捆绑包的

Secret对象。注: 如果 Red Hat OpenStack Platform 环境使用由多个授权机构签名的证书提供服务,则捆绑包必须包含证书以验证所有需要的端点。对名为ocp3的集群添加类似以下示例:apiVersion: v1 kind: Secret type: Opaque metadata: name: ocp3-openstack-trust namespace: ocp3 stringData: ca.crt: | -----BEGIN CERTIFICATE----- <Base64 certificate contents here> -----END CERTIFICATE----- -----BEGIN CERTIFICATE----- <Base64 certificate contents here> -----END CERTIFICATE----修改 Hive

ClusterDeployment对象,在spec.platform.openstack中指定 certificateSecretRef的值,如下例所示:platform: openstack: certificatesSecretRef: name: ocp3-openstack-trust credentialsSecretRef: name: ocp3-openstack-creds cloud: openstack前面的示例假定

clouds.yaml文件中的云名称为openstack。

如果您使用 Red Hat Advanced Cluster Management for Kubernetes,并希望将受管集群 klusterlet 配置为在特定节点上运行,请参阅 可选:配置 klusterlet 以在特定节点上运行 所需步骤。

注: 您不必运行 oc 命令,它为导入集群提供集群详情。创建集群时,它由 multicluster engine operator 管理自动配置。

如需了解更多与访问集群相关的信息,继续访问集群。

1.7.3.9. 在内部环境中创建集群

您可以使用控制台创建内部 Red Hat OpenShift Container Platform 集群。集群可以是单节点 OpenShift 集群、多节点集群和紧凑的三节点集群,可以在 VMware vSphere、Red Hat OpenStack, Nutanix 或裸机环境中进行。

没有与安装集群的平台集成,因为平台值设置为 platform=none。单节点 OpenShift 集群仅包含一个节点,用于托管 control plane 服务和用户工作负载。当您要最小化集群资源占用空间时,此配置很有用。

您还可以使用零接触置备功能在边缘资源中置备多个单节点 OpenShift 集群,它是一个 Red Hat OpenShift Container Platform 提供的功能。有关零接触置备的更多信息,请参阅 OpenShift Container Platform 文档中的 网络边缘集群。

1.7.3.9.1. 先决条件

在内部环境中创建集群前需要满足以下先决条件:

- 您必须在受支持的 OpenShift Container Platform 版本中部署了 hub 集群。

- 您需要一个已配置的基础架构环境,其中含有配置的主机清单。

- 您必须对 hub 集群(连接)或者连接到连接到互联网(断开连接)的内部或镜像 registry 的连接,以检索创建集群所需的镜像。

- 您需要配置了内部凭证。

- 您需要 OpenShift Container Platform 镜像 pull secret。请参阅使用镜像 pull secret。

您需要以下 DNS 记录:

以下 API 基域必须指向静态 API VIP:

api.<cluster_name>.<base_domain>以下应用程序基域必须指向 Ingress VIP 的静态 IP 地址:

*.apps.<cluster_name>.<base_domain>

-

查看 hub 集群

KubeAPIServer证书验证策略,以确保默认的UseAutoDetectedCABundle策略可以正常工作。如果需要手动更改策略,请参阅配置 hub 集群KubeAPIServer验证策略。

1.7.3.9.2. 使用控制台创建集群

要从控制台创建集群,请完成以下步骤:

- 进入 Infrastructure > Clusters。

- 在 Clusters 页面上,点 Create cluster 并完成控制台中的步骤。

- 选择 Host inventory 作为集群的类型。

以下选项可用于您的支持安装:

- 使用现有的发现的主机 :从现有主机清单中的主机列表中选择您的主机。

- 发现新主机 :发现不在现有基础架构环境中的主机。发现您自己的主机,而不是使用已在基础架构环境中的主机。

如果您需要创建凭证,请参阅 为内部环境创建凭证。

集群的名称用于集群的主机名。

重要: 当您创建集群时,控制器会为集群及其资源创建一个命名空间。确保只在该命名空间中包含该集群实例的资源。销毁集群会删除命名空间和所有资源。

注: 在控制台中输入信息时,选择 YAML: On 查看内容更新。

如果要将集群添加到现有的集群集中,则需要在集群设置上具有正确的权限来添加它。如果在创建集群时没有 cluster-admin 权限,则必须选择一个具有 clusterset-admin 权限的集群集。如果您在指定的集群集中没有正确的权限,集群创建会失败。如果您没有任何集群集选项,请联络您的集群管理员,为集群集提供 clusterset-admin 权限。

每个受管集群都必须与受管集群集关联。如果您没有将受管集群分配给 ManagedClusterSet,则会自动添加到 default 受管集群集中。

如果已有与您为供应商帐户配置的所选凭证关联的基本 DNS 域,则该值会在那个字段中填充。您可以通过覆盖它来更改值,但创建集群后无法更改此设置。此基础域用于创建到 OpenShift Container Platform 集群组件的路由。它在集群供应商的 DNS 中被配置为授权起始(SOA)记录。

OpenShift 版本 标识用于创建集群的 OpenShift Container Platform 镜像的版本。如果要使用的版本可用,您可以从镜像列表中选择镜像。如果您要使用的镜像不是标准镜像,您可以输入您要使用的镜像的 URL。请参阅 发行镜像 以了解更多信息。

当您选择受支持的 OpenShift Container Platform 版本时,会显示一个选择 Install single-node OpenShift 的选项。单节点 OpenShift 集群仅包含一个节点,用于托管 control plane 服务和用户工作负载。请参阅 将主机扩展到 基础架构环境,以了解更多有关添加节点到单节点 OpenShift 集群的信息。

如果您希望集群是单节点 OpenShift 集群,请选择 单节点 OpenShift 选项。您可以通过完成以下步骤,向单节点 OpenShift 集群添加额外的 worker:

- 在控制台中,导航到 Infrastructure > Clusters,再选择您创建的或想要访问的集群的名称。

- 选择 Actions > Add hosts 来添加额外的 worker。

注: 单节点 OpenShift control plane 需要 8 个 CPU 内核,而多节点 control plane 集群的 control plane 节点只需要 4 个 CPU 内核。

查看并保存集群后,您的集群将保存为集群草稿。您可以通过在 Clusters 页面中选择集群名称来关闭创建过程,并在稍后完成该过程。

如果您使用的是现有主机,请选择是否要自行选择主机,还是自动选择它们。主机数量取决于您选择的节点数量。例如,单节点 OpenShift 集群只需要一个主机,而标准的三节点集群需要三个主机。

主机位置列表中显示了满足此集群要求的可用主机位置。对于主机的分发和更加高可用性的配置,请选择多个位置。

如果您发现没有现有基础架构环境的新主机,请使用 发现镜像完成将主机添加到主机清单 中的步骤。

绑定主机以及验证通过后,通过添加以下 IP 地址完成集群的网络信息:

API VIP:指定用于内部 API 通信的 IP 地址。

注: 这个值必须与您用来创建 prerequisites 部分中列出的 DNS 记录的名称匹配。如果没有提供,DNS 必须预先配置,以便

api.可以正确解析。Ingress VIP:指定用于入口流量的 IP 地址。

注: 这个值必须与您用来创建 prerequisites 部分中列出的 DNS 记录的名称匹配。如果没有提供,则必须预先配置 DNS,以便

test.apps可以被正确解析。

如果您使用 Red Hat Advanced Cluster Management for Kubernetes,并希望将受管集群 klusterlet 配置为在特定节点上运行,请参阅 可选:配置 klusterlet 以在特定节点上运行 所需步骤。

您可以在 Clusters 导航页面中查看安装状态。

如需了解更多与访问集群相关的信息,继续访问集群。

1.7.3.9.3. 使用命令行创建集群

您还可以使用中央基础架构管理组件中的 Assisted Installer 功能在没有控制台的情况下创建集群。完成此步骤后,您可以从生成的发现镜像引导主机。该流程的顺序通常并不重要,但在有必要顺序时请注意。

1.7.3.9.3.1. 创建命名空间

您需要一个命名空间来用于资源。更方便地将所有资源保留在共享命名空间中。本例使用 sample-namespace 作为命名空间的名称,但您可以使用除 assisted-installer 以外的任何名称。通过创建并应用以下文件来创建命名空间:

apiVersion: v1

kind: Namespace

metadata:

name: sample-namespace1.7.3.9.3.2. 将 pull secret 添加到命名空间中

通过创建并应用以下自定义资源,将 pull secret 添加到命名空间中:

apiVersion: v1

kind: Secret

type: kubernetes.io/dockerconfigjson

metadata:

name: <pull-secret>

namespace: sample-namespace

stringData:

.dockerconfigjson: 'your-pull-secret-json' 1.7.3.9.3.3. 创建 ClusterImageSet

通过创建并应用以下自定义资源,生成 CustomImageSet 以指定集群的 OpenShift Container Platform 版本:

apiVersion: hive.openshift.io/v1

kind: ClusterImageSet

metadata:

name: openshift-v4.15.0

spec:

releaseImage: quay.io/openshift-release-dev/ocp-release:4.15.0-rc.0-x86_64

注: 如果安装了一个与 hub 集群不同的架构,则需要创建一个多架构 ClusterImageSet。如需更多信息,请参阅创建发行镜像以在不同的架构上部署集群。

1.7.3.9.3.4. 创建 ClusterDeployment 自定义资源

ClusterDeployment 自定义资源定义是一个控制集群生命周期的 API。它会在定义集群参数的 spec.ClusterInstallRef 设置中引用 AgentClusterInstall 自定义资源。

根据以下示例创建并应用 ClusterDeployment 自定义资源:

apiVersion: hive.openshift.io/v1

kind: ClusterDeployment

metadata:

name: single-node

namespace: demo-worker4

spec:

baseDomain: hive.example.com

clusterInstallRef:

group: extensions.hive.openshift.io

kind: AgentClusterInstall

name: test-agent-cluster-install

version: v1beta1

clusterName: test-cluster

controlPlaneConfig:

servingCertificates: {}

platform:

agentBareMetal:

agentSelector:

matchLabels:

location: internal

pullSecretRef:

name: <pull-secret> - 1

- 使用

AgentClusterInstall资源的名称。 - 2

- 使用您下载的 pull secret 将 pull secret 添加到命名空间。

1.7.3.9.3.5. 创建 AgentClusterInstall 自定义资源

在 AgentClusterInstall 自定义资源中,您可以指定集群的许多要求。例如,您可以指定集群网络设置、平台、control plane 数量和 worker 节点。

创建并添加类似以下示例的自定义资源:

apiVersion: extensions.hive.openshift.io/v1beta1

kind: AgentClusterInstall

metadata:

name: test-agent-cluster-install

namespace: demo-worker4

spec:

platformType: BareMetal

clusterDeploymentRef:

name: single-node

imageSetRef:

name: openshift-v4.15.0

networking:

clusterNetwork:

- cidr: 10.128.0.0/14

hostPrefix: 23

machineNetwork:

- cidr: 192.168.111.0/24

serviceNetwork:

- 172.30.0.0/16

provisionRequirements:

controlPlaneAgents: 1

sshPublicKey: ssh-rsa <your-public-key-here> - 1

- 指定创建集群的环境的平台类型。有效值为:

BareMetal,None,VSphere,Nutanix, 或External. - 2

- 使用与

ClusterDeployment资源相同的名称。 - 3

- 使用在生成一个ClusterImageSet 中生成的

ClusterImageSet。 - 4

- 您可以指定您的 SSH 公钥,它可让您在安装后访问主机。

1.7.3.9.3.6. 可选:创建 NMStateConfig 自定义资源

只有在您有主机级别网络配置(如静态 IP 地址)时才需要 NMStateConfig 自定义资源。如果创建 NMStateConfig 自定义资源,则必须在创建 InfraEnv 自定义资源前完成此步骤。InfraEnv 自定义资源中的 spec.nmStateConfigLabelSelector 的值引用 NMStateConfig 自定义资源。

创建并应用您的 NMStateConfig 自定义资源,如下例所示。根据需要替换值:

apiVersion: agent-install.openshift.io/v1beta1

kind: NMStateConfig

metadata:

name: <mynmstateconfig>

namespace: <demo-worker4>

labels:

demo-nmstate-label: <value>

spec:

config:

interfaces:

- name: eth0

type: ethernet

state: up

mac-address: 02:00:00:80:12:14

ipv4:

enabled: true

address:

- ip: 192.168.111.30

prefix-length: 24

dhcp: false

- name: eth1

type: ethernet

state: up

mac-address: 02:00:00:80:12:15

ipv4:

enabled: true

address:

- ip: 192.168.140.30

prefix-length: 24

dhcp: false

dns-resolver:

config:

server:

- 192.168.126.1

routes:

config:

- destination: 0.0.0.0/0

next-hop-address: 192.168.111.1

next-hop-interface: eth1

table-id: 254

- destination: 0.0.0.0/0

next-hop-address: 192.168.140.1

next-hop-interface: eth1

table-id: 254

interfaces:

- name: "eth0"

macAddress: "02:00:00:80:12:14"

- name: "eth1"

macAddress: "02:00:00:80:12:15"重要:

-

您必须在

InfraEnv自定义资源中的spec.nmStateConfigLabelSelector.matchLabels字段中包含demo-nmstate-label标签名称和值。 - 在使用 DHCP 或静态网络协议时,您必须添加 MAC 地址。

要查看您可以添加到 spec.config 字段中的 NMState 的额外示例,请参阅 OpenShift Container Platform 的 Assisted Installer 文档中的 附加 NMState 配置示例。

1.7.3.9.3.7. 创建 InfraEnv 自定义资源

InfraEnv 自定义资源提供创建发现 ISO 的配置。在这个自定义资源中,您可以识别代理设置的值,ignition 覆盖并指定 NMState 标签。此自定义资源中的 spec.nmStateConfigLabelSelector 值引用 NMStateConfig 自定义资源。

注: 如果您计划包含可选的 NMStateConfig 自定义资源,则必须在 InfraEnv 自定义资源中引用它。如果您在创建 NMStateConfig 自定义资源前创建 InfraEnv 自定义资源,请编辑 InfraEnv 自定义资源来引用 NMStateConfig 自定义资源并在添加引用后下载 ISO。

创建并应用以下自定义资源:

apiVersion: agent-install.openshift.io/v1beta1

kind: InfraEnv

metadata:

name: myinfraenv

namespace: demo-worker4

spec:

clusterRef:

name: single-node

namespace: demo-worker4

pullSecretRef:

name: pull-secret

sshAuthorizedKey: <your_public_key_here>

nmStateConfigLabelSelector:

matchLabels:

demo-nmstate-label: value

proxy:

httpProxy: http://USERNAME:PASSWORD@proxy.example.com:PORT

httpsProxy: https://USERNAME:PASSWORD@proxy.example.com:PORT

noProxy: .example.com,172.22.0.0/24,10.10.0.0/24- 1

- 替换 Create the ClusterDeployment 的

clusterDeployment资源名称。 - 2

1.7.3.9.3.7.1. InfraEnv 字段表

| 字段 | 可选或必需的 | 描述 |

|---|---|---|

|

| 选填 | 您可以指定您的 SSH 公钥,这可让您在从发现 ISO 镜像引导时访问主机。 |

|

| 选填 |

合并高级网络配置,如主机的静态 IP、网桥和绑定。主机网络配置使用您选择的标签在一个或多个 |

|

| 选填 | 您可以在 proxy 部分发现过程中指定主机所需的代理设置。 |

注: 当使用 IPv6 置备时,您无法在 noProxy 设置中定义 CIDR 地址块。您必须单独定义每个地址。

1.7.3.9.3.8. 从发现镜像引导主机

剩余的步骤解释了如何从之前流程中结果的发现 ISO 镜像引导主机。

运行以下命令,从命名空间中下载发现镜像:

curl --insecure -o image.iso $(kubectl -n sample-namespace get infraenvs.agent-install.openshift.io myinfraenv -o=jsonpath="{.status.isoDownloadURL}")- 将发现镜像移到虚拟介质、USB 驱动器或其他存储位置,并从您下载的发现镜像引导主机。

Agent资源会自动创建。它已注册到集群,并代表从发现镜像引导的主机。运行以下命令批准Agent自定义资源并启动安装:oc -n sample-namespace patch agents.agent-install.openshift.io 07e80ea9-200c-4f82-aff4-4932acb773d4 -p '{"spec":{"approved":true}}' --type merge将代理名称和 UUID 替换为您的值。

当上一命令的输出包含目标集群的条目时,您可以确认它已被批准,其中包含

APPROVED参数的值为true。

1.7.3.9.4. 其他资源

- 有关使用 CLI 在 Nutanix 平台创建集群时需要的额外步骤,请参阅 Red Hat OpenShift Container Platform 文档中的使用 API 和 Nutanix 安装后配置 在 Nutanix 中添加主机。

- 有关零接触置备的更多信息,请参阅 OpenShift Container Platform 文档中的 网络边缘集群。

- 请参阅使用镜像 pull secret

- 请参阅为内部环境创建凭证

- 请参阅 发行镜像

- 请参阅使用发现镜像将主机添加到主机清单中

1.7.3.10. 在代理环境中创建集群

当 hub 集群通过代理服务器连接时,您可以创建 Red Hat OpenShift Container Platform 集群。要成功创建集群,则必须满足以下情况之一:

- multicluster engine operator 与您要创建的受管集群具有私有网络连接,使用代理访问互联网的受管集群。

- 受管集群位于基础架构供应商上,但防火墙端口启用从受管集群到 hub 集群的通信。

要创建使用代理配置的集群,请完成以下步骤:

通过将以下信息添加到存储于您的 Secret 中的

install-configYAML 中添加以下信息,在 hub 集群上配置cluster-wide-proxy设置 :apiVersion: v1 kind: Proxy baseDomain: <domain> proxy: httpProxy: http://<username>:<password>@<proxy.example.com>:<port> httpsProxy: https://<username>:<password>@<proxy.example.com>:<port> noProxy: <wildcard-of-domain>,<provisioning-network/CIDR>,<BMC-address-range/CIDR>使用代理服务器的用户名替换

username。使用密码替换

password以访问您的代理服务器。将

proxy.example.com替换为代理服务器的路径。使用与代理服务器的通信端口替换

port。将

wildcard-of-domain替换为应当绕过代理的域的条目。使用置备网络的 IP 地址和分配的 IP 地址(以 CIDR 表示)替换

provisioning-network/CIDR。将

BMC-address-range/CIDR替换为 BMC 地址和地址数(以 CIDR 表示)。- 通过完成创建集群的步骤来置备集群。请参阅创建集群以选择您的供应商。

注: 您只能在部署集群时使用 install-config YAML。部署集群后,您对 install-config YAML 所做的任何新更改都不会应用。要在部署后更新配置,您必须使用策略。如需更多信息,请参阅 Pod 策略。

1.7.3.10.1. 其他资源

1.7.3.11. 配置 AgentClusterInstall 代理

AgentClusterInstall 代理字段会在安装过程中决定代理设置,并用于在创建的集群中创建集群范围代理资源。

1.7.3.11.1. 配置 AgentClusterInstall

要配置 AgentClusterInstall 代理,请将 代理设置 添加到 AgentClusterInstall 资源中。请参阅以下带有 httpProxy、httpsProxy 和 noProxy 的 YAML 示例:

apiVersion: extensions.hive.openshift.io/v1beta1

kind: AgentClusterInstall

spec:

proxy:

httpProxy: http://<username>:<password>@<proxy.example.com>:<port>

httpsProxy: https://<username>:<password>@<proxy.example.com>:<port>

noProxy: <wildcard-of-domain>,<provisioning-network/CIDR>,<BMC-address-range/CIDR> - 1

httpProxy是 HTTP 请求的代理 URL。将 username 和 password 值替换为您的代理服务器的凭证。将proxy.example.com替换为代理服务器的路径。- 2

httpsProxy是 HTTPS 请求的代理 URL。将值替换为您的凭证。使用与代理服务器的通信端口替换port。- 3

noProxy是一个以逗号分隔的域列表,以及不应使用代理的 CIDR。将wildcard-of-domain替换为应当绕过代理的域的条目。使用置备网络的 IP 地址和分配的 IP 地址(以 CIDR 表示)替换provisioning-network/CIDR。将BMC-address-range/CIDR替换为 BMC 地址和地址数(以 CIDR 表示)。

1.7.3.11.2. 其他资源

1.7.4. 集群导入

您可以从不同的 Kubernetes 云供应商导入集群。导入后,目标集群成为 multicluster engine operator hub 集群的受管集群。通常,您可以完成任何可以访问 hub 集群和目标受管集群的导入任务,除非另有指定。

- hub 集群无法管理任何其他 hub 集群,但可以管理自己。hub 集群被配置为自动导入和自助管理。您不需要手动导入 hub 集群。

-

如果删除了 hub 集群并尝试再次导入它,您必须将

local-cluster:true标签添加到ManagedCluster资源中。

重要: 集群生命周期现在支持所有通过云原生计算基础(CNCF) Kubernetes 一致性计划认证的供应商。为混合云多集群管理选择 CNCF 可识别的供应商。

请参阅以下有关使用 CNCF 供应商的信息:

- 了解 CNCF 供应商如何通过认证的 Kubernetes 一致性进行认证。

- 有关 CNCF 第三方供应商的信息,请参阅红帽 与第三方组件的支持,或 联系红帽支持。

-

如果您具有自己的 CNCF 一致性认证集群,您需要将 OpenShift Container Platform CLI

oc命令改为 Kubernetes CLI 命令kubectl。

阅读以下主题以了解更多有关导入集群的信息,以便您可以管理它:

所需的用户类型或访问权限级别:集群管理员

1.7.4.1. 使用控制台导入受管集群

为 Kubernetes operator 安装多集群引擎后,就可以导入集群来管理。继续阅读以下主题,了解如何使用控制台导入受管集群:

1.7.4.1.1. 先决条件

- 已部署 hub 集群。如果要导入裸机集群,必须在受支持的 Red Hat OpenShift Container Platform 版本上安装 hub 集群。

- 您要管理的集群。

-

base64命令行工具。 -

如果您要导入不是由 OpenShift Container Platform 创建的集群,则定义的

multiclusterhub.spec.imagePullSecret。安装 Kubernetes operator 的多集群引擎时,可能已创建了此 secret。如需有关如何定义此 secret 的更多信息,请参阅自定义镜像 pull secret。 -

查看 hub 集群

KubeAPIServer证书验证策略,以确保默认的UseAutoDetectedCABundle策略可以正常工作。如果需要手动更改策略,请参阅配置 hub 集群KubeAPIServer验证策略。

所需的用户类型或访问权限级别:集群管理员

1.7.4.1.2. 创建新的 pull secret

如果您需要创建新的 pull secret,请完成以下步骤:

- 从 cloud.redhat.com 下载 Kubernetes pull secret。

- 将 pull secret 添加到 hub 集群的命名空间。

运行以下命令,在

open-cluster-management命名空间中创建新 secret:oc create secret generic pull-secret -n <open-cluster-management> --from-file=.dockerconfigjson=<path-to-pull-secret> --type=kubernetes.io/dockerconfigjson将

open-cluster-management替换为 hub 集群的命名空间的名称。hub 集群的默认命名空间是open-cluster-management。将

path-to-pull-secret替换为您下载的 pull secret 的路径。在导入时,secret 会自动复制到受管集群。

-

确保从您要导入的集群中删除了之前安装的代理。您必须删除

open-cluster-management-agent和open-cluster-management-agent-addon命名空间以避免错误。 有关在 Red Hat OpenShift Dedicated 环境中导入,请参阅以下备注:

- 您必须在 Red Hat OpenShift Dedicated 环境中部署了 hub 集群。

-

Red Hat OpenShift Dedicated 的默认权限是 dedicated-admin,但不包含创建命名空间的所有权限。您必须具有

cluster-admin权限才能导入和管理使用多集群引擎 operator 的集群。

-

确保从您要导入的集群中删除了之前安装的代理。您必须删除

1.7.4.1.3. 导入集群

您可从控制台导入每个可用的云供应商的现有集群。

注: hub 集群无法管理不同的 hub 集群。hub 集群被设置为自动导入和管理自身,因此您不必手动导入 hub 集群来管理自己。

默认情况下,命名空间用于集群名称和命名空间,但您可以更改它。

重要: 当您创建集群时,控制器会为集群及其资源创建一个命名空间。确保只在该命名空间中包含该集群实例的资源。销毁集群会删除命名空间和所有资源。

每个受管集群都必须与受管集群集关联。如果您没有将受管集群分配给 ManagedClusterSet,集群会自动添加到 default 受管集群集中。

如果要将集群添加到不同的集群集合中,集群集必须具有 clusterset-admin 权限。如果在导入集群时没有 cluster-admin 权限,则必须选择一个具有 clusterset-admin 权限的集群集。如果您在指定的集群集合中没有正确的权限,集群导入会失败。如果没有要选择的集群设置选项,请联系集群管理员,为集群集提供 clusterset-admin 权限。

如果您导入 OpenShift Container Platform Dedicated 集群,且没有通过为 vendor=OpenShiftDedicated 添加标签来指定供应商,或者为 vendor=auto-detect 添加标签,则 managed-by=platform 标签会自动添加到集群中。您可以使用此添加的标签将集群识别为 OpenShift Container Platform Dedicated 集群,并作为组检索 OpenShift Container Platform Dedicated 集群。

下表提供了 导入模式 的可用选项,它指定导入集群的方法:

| 手动运行导入命令 | 在控制台中完成并提交信息(包括任何 Red Hat Ansible Automation Platform 模板)后,在目标集群上运行提供的命令来导入集群。 |

| 为现有集群输入服务器 URL 和 API 令牌 | 提供您要导入的集群的服务器 URL 和 API 令牌。您可以指定一个在升级集群时运行的 Red Hat Ansible Automation Platform 模板。 |

|

提供 |

复制并粘贴您要导入的集群的 |

注: 您必须从 OperatorHub 安装 Red Hat Ansible Automation Platform Resource Operator,才能创建并运行 Ansible Automation Platform 作业。

要配置集群 API 地址,请参阅 可选:配置集群 API 地址。

要将受管集群 klusterlet 配置为在特定节点上运行,请参阅 可选:将 klusterlet 配置为在特定节点上运行。

1.7.4.1.3.1. 可选:配置集群 API 地址

完成以下步骤,通过配置运行 oc get managedcluster 命令时在表中显示的 URL 来选择性地配置集群详情页面上的 Cluster API 地址 :

-

使用具有

cluster-admin权限的 ID 登录到 hub 集群。 -

为目标受管集群配置

kubeconfig文件。 运行以下命令编辑您要导入的集群的受管集群条目,将

cluster-name替换为受管集群的名称:oc edit managedcluster <cluster-name>在 YAML 文件中的

ManagedClusterspec 中添加ManagedClusterClientConfigs,如下例所示:spec: hubAcceptsClient: true managedClusterClientConfigs: - url: <https://api.new-managed.dev.redhat.com>1 - 1

- 将 URL 值替换为提供对您要导入的受管集群的外部访问的 URL。

1.7.4.1.3.2. 可选:将 klusterlet 配置为在特定节点上运行

您可以通过为受管集群配置 nodeSelector 和 tolerations 注解来指定您希望受管集群 klusterlet 运行哪些节点。完成以下步骤以配置这些设置:

- 从控制台的集群页面中选择您要更新的受管集群。

将 YAML 开关设置为

On以查看 YAML 内容。注: YAML 编辑器仅在导入或创建集群时可用。要在导入或创建后编辑受管集群 YAML 定义,您必须使用 OpenShift Container Platform 命令行界面或 Red Hat Advanced Cluster Management 搜索功能。

-

在受管集群 YAML 定义中添加

nodeSelector注解。此注解的键为:open-cluster-management/nodeSelector。此注解的值是具有 JSON 格式的字符串映射。 在受管集群 YAML 定义中添加

tolerations条目。此注解的键为:open-cluster-management/tolerations。此注解的值代表具有 JSON 格式的 容限 列表。生成的 YAML 可能类似以下示例:apiVersion: cluster.open-cluster-management.io/v1 kind: ManagedCluster metadata: annotations: open-cluster-management/nodeSelector: '{"dedicated":"acm"}' open-cluster-management/tolerations: '[{"key":"dedicated","operator":"Equal","value":"acm","effect":"NoSchedule"}]'

您还可以使用 KlusterletConfig 为受管集群配置 nodeSelector 和 tolerations。完成以下步骤以配置这些设置:

注: 如果您使用 KlusterletConfig,受管集群使用 KlusterletConfig 设置中的配置,而不是受管集群注解中的设置。

应用以下示例 YAML 内容。根据需要替换值:

apiVersion: config.open-cluster-management.io/v1alpha1 kind: KlusterletConfig metadata: name: <klusterletconfigName> spec: nodePlacement: nodeSelector: dedicated: acm tolerations: - key: dedicated operator: Equal value: acm effect: NoSchedule-

将

agent.open-cluster-management.io/klusterlet-config: '<klusterletconfigName> 注解添加到受管集群,将 <klusterletconfigName> 替换为KlusterletConfig的名称。

1.7.4.1.4. 删除导入的集群

完成以下步骤以删除导入的集群以及在受管集群上创建的 open-cluster-management-agent-addon。

在 Clusters 页面上,点 Actions > Detach cluster 从管理中删除集群。

注意: 如果您试图分离名为 local-cluster 的 hub 集群,请注意 disableHub selfManagement 的默认设置为 false 。此设置会导致 hub 集群在分离时会重新导入自己并管理自己,并协调 MultiClusterHub 控制器。hub 集群可能需要几小时时间来完成分离过程并重新导入。如果要在等待进程完成的情况下重新导入 hub 集群,您可以运行以下命令来重启 multiclusterhub-operator pod 并更快地重新导入:

oc delete po -n open-cluster-management `oc get pod -n open-cluster-management | grep multiclusterhub-operator| cut -d' ' -f1`

您可以通过将 disableHubSelfManagement 值改为 true 来更改 hub 集群的值,使其不会自动导入。如需更多信息,请参阅 disableHubSelfManagement 主题。

1.7.4.1.4.1. 其他资源

- 如需有关如何定义 自定义镜像 pull secret 的更多信息,请参阅自定义镜像 pull secret。

- 请参阅 disableHubSelfManagement 主题。

1.7.4.2. 使用 CLI 导入受管集群

在为 Kubernetes operator 安装多集群引擎后,就可以使用 Red Hat OpenShift Container Platform CLI 导入集群并管理它。继续阅读以下主题,了解如何使用自动导入 secret 或使用手动命令通过 CLI 导入受管集群。

重要: hub 集群无法管理不同的 hub 集群。hub 集群被设置为自动导入和管理 本地集群。您不必手动导入 hub 集群来自己管理。如果您删除了 hub 集群并尝试再次导入它,则需要添加 local-cluster:true 标签。

1.7.4.2.1. 先决条件

- 已部署 hub 集群。如果要导入裸机集群,必须在受支持的 OpenShift Container Platform 版本上安装 hub 集群。

- 您要管理的单独集群。

- OpenShift Container Platform CLI。如需有关安装和配置 OpenShift Container Platform CLI 的信息,请参阅 OpenShift CLI 入门。

-

如果您要导入不是由 OpenShift Container Platform 创建的集群,则定义的

multiclusterhub.spec.imagePullSecret。安装 Kubernetes operator 的多集群引擎时,可能已创建了此 secret。如需有关如何定义此 secret 的更多信息,请参阅自定义镜像 pull secret。 -

查看 hub 集群

KubeAPIServer证书验证策略,以确保默认的UseAutoDetectedCABundle策略可以正常工作。如果需要手动更改策略,请参阅配置 hub 集群KubeAPIServer验证策略。

1.7.4.2.2. 支持的构架

- Linux (x86_64, s390x, ppc64le)

- macOS

1.7.4.2.3. 准备集群导入

在使用 CLI 导入受管集群前,您必须完成以下步骤:

运行以下命令登录到您的 hub 集群:

oc login在 hub 集群中运行以下命令以创建项目和命名空间。<

cluster_name> 中定义的集群名称也用作 YAML 文件和命令中的集群命名空间:oc new-project <cluster_name>重要:

cluster.open-cluster-management.io/managedCluster标签会自动添加到受管集群命名空间中并从中删除。不要手动将其添加到受管集群命名空间中或从受管集群命名空间中删除。使用以下示例内容,创建一个名为

managed-cluster.yaml的文件:apiVersion: cluster.open-cluster-management.io/v1 kind: ManagedCluster metadata: name: <cluster_name> labels: cloud: auto-detect vendor: auto-detect spec: hubAcceptsClient: true当

cloud和vendor的值被设置为auto-detect时,Red Hat Advanced Cluster Management 会检测您要导入的集群的云和厂商类型。您可以选择将auto-detect的值替换为集群的 cloud 和 vendor 值。请参见以下示例:cloud: Amazon vendor: OpenShift运行以下命令,将 YAML 文件应用到

ManagedCluster资源:oc apply -f managed-cluster.yaml

现在,您可以使用 自动导入 secret 或 手动导入集群来继续导入集群。

1.7.4.2.4. 使用自动导入 secret 功能导入集群

要使用自动导入 secret 导入受管集群,您必须创建一个 secret,该 secret 包含集群的 kubeconfig 文件,或者集群的 kube API 服务器和令牌对。完成以下步骤,使用自动导入 secret 导入集群:

-

检索您要导入的受管集群的

kubeconfig文件或 kube API 服务器和令牌。请参阅 Kubernetes 集群的文档,了解在哪里可以找到您的kubeconfig文件或 kube API 服务器和令牌。 在 ${CLUSTER_NAME} 命名空间中创建

auto-import-secret.yaml文件。使用类似以下模板的内容,创建一个名为

auto-import-secret.yaml的 YAML 文件:apiVersion: v1 kind: Secret metadata: name: auto-import-secret namespace: <cluster_name> stringData: autoImportRetry: "5" # If you are using the kubeconfig file, add the following value for the kubeconfig file # that has the current context set to the cluster to import: kubeconfig: |- <kubeconfig_file> # If you are using the token/server pair, add the following two values instead of # the kubeconfig file: token: <Token to access the cluster> server: <cluster_api_url> type: Opaque运行以下命令,应用 <cluster_name> 命名空间中的 YAML 文件:

oc apply -f auto-import-secret.yaml注: 默认情况下,自动导入 secret 只使用一次,在导入过程完成后会被删除。如果要保留自动导入 secret,请将

managedcluster-import-controller.open-cluster-management.io/keeping-auto-import-secret添加到 secret。您可以运行以下命令来添加它:oc -n <cluster_name> annotate secrets auto-import-secret managedcluster-import-controller.open-cluster-management.io/keeping-auto-import-secret=""

验证您的导入集群的

JOINED和AVAILABLE状态。在 hub 集群中运行以下命令:oc get managedcluster <cluster_name>在集群中运行以下命令来登录到受管集群:

oc login您可以运行以下命令来验证您要导入的集群中的 pod 状态:

oc get pod -n open-cluster-management-agent

1.7.4.2.5. 手动导入集群

重要: 导入命令包含复制到每个导入受管集群的 pull secret 信息。具有访问导入集群权限的所有用户都可以查看 pull secret 信息。

完成以下步骤以手动导入受管集群:

运行以下命令,获取由导入控制器在 hub 集群上生成的

klusterlet-crd.yaml文件:oc get secret <cluster_name>-import -n <cluster_name> -o jsonpath={.data.crds\\.yaml} | base64 --decode > klusterlet-crd.yaml运行以下命令,获取导入控制器在 hub 集群上生成的

import.yaml文件:oc get secret <cluster_name>-import -n <cluster_name> -o jsonpath={.data.import\\.yaml} | base64 --decode > import.yaml在要导入的集群中执行以下步骤:

输入以下命令登录到您导入的受管集群:

oc login运行以下命令应用您在第 1 步中生成的

klusterlet-crd.yaml:oc apply -f klusterlet-crd.yaml运行以下命令应用您之前生成的

import.yaml文件:oc apply -f import.yaml您可以通过从 hub 集群中运行以下命令来验证您要导入的受管集群的

JOINED和AVAILABLE状态:oc get managedcluster <cluster_name>

1.7.4.2.6. 导入 klusterlet 附加组件

实施 KlusterletAddonConfig klusterlet 附加组件配置,以在受管集群中启用其他附加组件。通过完成以下步骤创建并应用配置文件:

创建一个类似以下示例的 YAML 文件:

apiVersion: agent.open-cluster-management.io/v1 kind: KlusterletAddonConfig metadata: name: <cluster_name> namespace: <cluster_name> spec: applicationManager: enabled: true certPolicyController: enabled: true policyController: enabled: true searchCollector: enabled: true-

将文件保存为

klusterlet-addon-config.yaml。 运行以下命令来应用 YAML:

oc apply -f klusterlet-addon-config.yaml附加组件会在您导入的受管集群状态后安装为

AVAILABLE。您可以运行以下命令来验证您要导入的集群上附加组件的 pod 状态:

oc get pod -n open-cluster-management-agent-addon

1.7.4.2.7. 使用命令行界面删除导入的集群

要使用命令行界面删除受管集群,请运行以下命令:

oc delete managedcluster <cluster_name>

将 <cluster_name > 替换为集群的名称。

1.7.4.3. 使用代理注册导入受管集群

在为 Kubernetes operator 安装多集群引擎后,就可以导入集群并使用代理注册端点管理它。继续阅读以下主题,了解如何使用代理注册端点导入受管集群。

1.7.4.3.1. 先决条件

- 已部署 hub 集群。如果要导入裸机集群,必须在受支持的 OpenShift Container Platform 版本上安装 hub 集群。

- 您要管理的集群。

-

base64命令行工具。 如果您要导入不是由 OpenShift Container Platform 创建的集群,则定义的

multiclusterhub.spec.imagePullSecret。安装 Kubernetes operator 的多集群引擎时,可能已创建了此 secret。如需有关如何定义此 secret 的更多信息,请参阅自定义镜像 pull secret。如果需要创建新 secret,请参阅 创建新的 pull secret。

1.7.4.3.2. 支持的构架

- Linux (x86_64, s390x, ppc64le)

- macOS

1.7.4.3.3. 导入集群

要使用代理注册端点导入受管集群,请完成以下步骤:

在 hub 集群中运行以下命令来获取代理注册服务器 URL:

export agent_registration_host=$(oc get route -n multicluster-engine agent-registration -o=jsonpath="{.spec.host}")注: 如果您的 hub 集群使用集群范围的代理,请确保使用受管集群可访问的 URL。

运行以下命令来获取 cacert :

oc get configmap -n kube-system kube-root-ca.crt -o=jsonpath="{.data['ca\.crt']}" > ca.crt_注: 如果您没有使用

kube-root-ca发布的端点,请使用 publicagent-registrationAPI 端点 CA 而不是kube-root-caCA。通过应用以下 YAML 内容来获取代理注册的令牌:

apiVersion: v1 kind: ServiceAccount metadata: name: managed-cluster-import-agent-registration-sa namespace: multicluster-engine --- apiVersion: v1 kind: Secret type: kubernetes.io/service-account-token metadata: name: managed-cluster-import-agent-registration-sa-token namespace: multicluster-engine annotations: kubernetes.io/service-account.name: "managed-cluster-import-agent-registration-sa" --- apiVersion: rbac.authorization.k8s.io/v1 kind: ClusterRole metadata: name: managedcluster-import-controller-agent-registration-client rules: - nonResourceURLs: ["/agent-registration/*"] verbs: ["get"] --- kind: ClusterRoleBinding apiVersion: rbac.authorization.k8s.io/v1 metadata: name: managed-cluster-import-agent-registration roleRef: apiGroup: rbac.authorization.k8s.io kind: ClusterRole name: managedcluster-import-controller-agent-registration-client subjects: - kind: ServiceAccount name: managed-cluster-import-agent-registration-sa namespace: multicluster-engine运行以下命令以导出令牌:

export token=$(oc get secret -n multicluster-engine managed-cluster-import-agent-registration-sa-token -o=jsonpath='{.data.token}' | base64 -d)运行以下命令,启用自动批准并将内容修补到

cluster-manager:oc patch clustermanager cluster-manager --type=merge -p '{"spec":{"registrationConfiguration":{"featureGates":[ {"feature": "ManagedClusterAutoApproval", "mode": "Enable"}], "autoApproveUsers":["system:serviceaccount:multicluster-engine:agent-registration-bootstrap"]}}}'注: 您还可以禁用自动批准,并手动批准来自受管集群的证书签名请求。

运行以下命令切换到受管集群并获取 cacert :

curl --cacert ca.crt -H "Authorization: Bearer $token" https://$agent_registration_host/agent-registration/crds/v1 | oc apply -f -运行以下命令,将受管集群导入到 hub 集群。将

<clusterName> 替换为集群的名称。将<duration> 替换为时间值。例如,4h:可选: 将

<klusterletconfigName> 替换为 KlusterletConfig 的名称。curl --cacert ca.crt -H "Authorization: Bearer $token" https://$agent_registration_host/agent-registration/manifests/<clusterName>?klusterletconfig=<klusterletconfigName>&duration=<duration> | oc apply -f -注: 如果没有设置持续时间,klusterlet 清单中的

kubeconfigbootstrap 不会过期。

为 Kubernetes operator 安装多集群引擎后,就可以导入受管集群。您可以导入现有的 OpenShift Container Platform 集群,以便您可以添加额外的节点。继续阅读以下主题以了解更多信息:

1.7.4.4.1. 先决条件

- 启用中央基础架构管理功能。

1.7.4.4.2. 导入集群

完成以下步骤,手动导入 OpenShift Container Platform 集群,没有静态网络或裸机主机,并准备它来添加节点:

通过应用以下 YAML 内容,为要导入的 OpenShift Container Platform 集群创建一个命名空间:

apiVersion: v1 kind: Namespace metadata: name: managed-cluster通过应用以下 YAML 内容,确保与您导入的 OpenShift Container Platform 集群匹配的 ClusterImageSet 已存在:

apiVersion: hive.openshift.io/v1 kind: ClusterImageSet metadata: name: openshift-v4.15 spec: releaseImage: quay.io/openshift-release-dev/ocp-release@sha256:22e149142517dfccb47be828f012659b1ccf71d26620e6f62468c264a7ce7863通过应用以下 YAML 内容来添加 pull secret 以访问镜像:

apiVersion: v1 kind: Secret type: kubernetes.io/dockerconfigjson metadata: name: pull-secret namespace: managed-cluster stringData: .dockerconfigjson: <pull-secret-json>1 - 1

- 将 <pull-secret-json> 替换为您的 pull secret JSON。

将

kubeconfig从 OpenShift Container Platform 集群复制到 hub 集群。运行以下命令,从 OpenShift Container Platform 集群获取

kubeconfig。确保将kubeconfig设置为要导入的集群:oc get secret -n openshift-kube-apiserver node-kubeconfigs -ojson | jq '.data["lb-ext.kubeconfig"]' --raw-output | base64 -d > /tmp/kubeconfig.some-other-cluster注: 如果通过自定义域访问集群 API,您必须首先通过在

certificate-authority-data字段中添加自定义证书来编辑此kubeconfig,并通过更改server字段以匹配您的自定义域。运行以下命令,将

kubeconfig复制到 hub 集群。确保将kubeconfig设置为 hub 集群:oc -n managed-cluster create secret generic some-other-cluster-admin-kubeconfig --from-file=kubeconfig=/tmp/kubeconfig.some-other-cluster

通过应用以下 YAML 内容来创建

AgentClusterInstall自定义资源。根据需要替换值:apiVersion: extensions.hive.openshift.io/v1beta1 kind: AgentClusterInstall metadata: name: <your-cluster-name>1 namespace: <managed-cluster> spec: networking: userManagedNetworking: true clusterDeploymentRef: name: <your-cluster> imageSetRef: name: openshift-v4.11.18 provisionRequirements: controlPlaneAgents:2 sshPublicKey: <"">3 通过应用以下 YAML 内容来创建

ClusterDeployment:根据需要替换值:apiVersion: hive.openshift.io/v1 kind: ClusterDeployment metadata: name: <your-cluster-name>1 namespace: managed-cluster spec: baseDomain: <redhat.com>2 installed: <true>3 clusterMetadata: adminKubeconfigSecretRef: name: <your-cluster-name-admin-kubeconfig>4 clusterID: <"">5 infraID: <"">6 clusterInstallRef: group: extensions.hive.openshift.io kind: AgentClusterInstall name: your-cluster-name-install version: v1beta1 clusterName: your-cluster-name platform: agentBareMetal: pullSecretRef: name: pull-secret通过应用以下 YAML 内容,添加一个

InfraEnv自定义资源来发现要添加到集群中的新主机。根据需要替换值:注:如果您使用静态 IP 地址,以下示例可能需要其他配置。

apiVersion: agent-install.openshift.io/v1beta1 kind: InfraEnv metadata: name: your-infraenv namespace: managed-cluster spec: clusterRef: name: your-cluster-name namespace: managed-cluster pullSecretRef: name: pull-secret sshAuthorizedKey: ""

| 字段 | 可选或必需的 | 描述 |

|---|---|---|

|

| 选填 |

如果您使用晚绑定,则 |

|

| 选填 |

添加可选的 |

如果导入成功,则会出现下载 ISO 文件的 URL。运行以下命令下载 ISO 文件,将 <url> 替换为显示的 URL:

注: 您可以使用裸机主机自动执行主机发现。

oc get infraenv -n managed-cluster some-other-infraenv -ojson | jq ".status.<url>" --raw-output | xargs curl -k -o /storage0/isos/some-other.iso-

可选: 如果要在 OpenShift Container Platform 集群中使用 Red Hat Advanced Cluster Management 功能,如策略,请创建一个

ManagedCluster资源。确保ManagedCluster资源的名称与ClusterDeplpoyment资源的名称匹配。如果缺少ManagedCluster资源,则在控制台中将断开集群状态。

1.7.4.4.3. 导入集群资源

如果 OpenShift Container Platform 受管集群由 Assisted Installer 安装,您可以将受管集群及其资源从一个 hub 集群移到另一个 hub 集群。

您可以通过保存原始资源的副本来从新的 hub 集群中管理集群,将其应用到新的 hub 集群,并删除原始资源。然后,您可以从新的 hub 集群缩减或扩展受管集群。

重要: 只有由 Assisted Installer 安装时,才能缩减导入的 OpenShift Container Platform 受管集群。

您可以导入以下资源,并继续使用它们管理集群:

| 资源 | 可选或必需的 | 描述 |

|---|---|---|

|

| 必填 | |

|

| 选填 | 如果要使用过滤器查询对 Agents 进行分类,则需要此项。 |

|

| 必填 | |

|

| 选填 |

如果您使用 |

|

| 必填 | |

|

| 必填 | |

|

| 选填 | 如果要在主机上应用网络配置,则需要此项。 |

|

| 必填 | |

|

| 必填 |

需要 |

1.7.4.4.3.1. 保存并应用受管集群资源

要保存受管集群资源的副本并将其应用到新的 hub 集群,请完成以下步骤:

运行以下命令,从源 hub 集群获取您的资源。根据需要替换值:

oc –kubeconfig <source_hub_kubeconfig> -n <managed_cluster_name> get <resource_name> <cluster_provisioning_namespace> -oyaml > <resource_name>.yaml-

通过将 <

resource_name>替换为资源的名称,为您要导入的每个资源重复该命令。

-

通过将 <

运行以下命令,从以下资源中删除

ownerReferences属性:AgentClusterInstallyq --in-place -y 'del(.metadata.ownerReferences)' AgentClusterInstall.yamlSecret(admin-kubeconfig)yq --in-place -y 'del(.metadata.ownerReferences)' AdminKubeconfigSecret.yaml

运行以下命令,将受管集群从源 hub 集群分离。根据需要替换值:

oc –kubeconfig <target_hub_kubeconfig> delete ManagedCluster <cluster_name>- 在目标 hub 集群上为受管集群创建一个命名空间。使用与源 hub 集群类似的名称。

运行以下命令,在目标 hub 集群中单独应用您的存储资源。根据需要替换值:

注: 如果要将所有资源作为组而不是单独应用,请将

<resource_name>.yaml替换为。oc –kubeconfig <target_hub_kubeconfig> apply -f <resource_name>.yaml

1.7.4.4.3.2. 从源 hub 集群中删除受管集群

导入集群资源后,通过完成以下步骤从源 hub 集群中删除受管集群:

-

在

ClusterDeployment自定义资源中将spec.preserveOnDelete参数设置为true,以防止销毁受管集群。 - 完成 从管理中删除集群 中的步骤。

1.7.4.5. 在受管集群中指定镜像 registry 进行导入

您可能需要覆盖您要导入的受管集群上的镜像 registry。您可以通过创建一个 ManagedClusterImageRegistry 自定义资源定义来完成此操作。

ManagedClusterImageRegistry 自定义资源定义是一个命名空间范围的资源。

ManagedClusterImageRegistry 自定义资源定义为要选择的放置指定一组受管集群,但需要与自定义镜像 registry 不同的镜像。使用新镜像更新受管集群后,会在每个受管集群中添加以下标签进行识别: open-cluster-management.io/image-registry=<namespace>.<managedClusterImageRegistryName>。

以下示例显示了 ManagedClusterImageRegistry 自定义资源定义:

apiVersion: imageregistry.open-cluster-management.io/v1alpha1

kind: ManagedClusterImageRegistry

metadata:

name: <imageRegistryName>

namespace: <namespace>

spec:

placementRef:

group: cluster.open-cluster-management.io

resource: placements

name: <placementName>

pullSecret:

name: <pullSecretName>

registries:

- mirror: <mirrored-image-registry-address>

source: <image-registry-address>

- mirror: <mirrored-image-registry-address>

source: <image-registry-address>- 1

- 使用选择一组受管集群的同一命名空间中的放置名称替换。

- 2

- 使用从自定义镜像 registry 中拉取镜像的 pull secret 的名称替换。

- 3

- 列出每个

source和mirrorregistry 的值。将mirrored-image-registry-address和image-registry-address替换为每个 registry 的mirror和source的值。-

示例 1:要将名为

registry.redhat.io/rhacm2的源 registry 替换为localhost:5000/rhacm2,并将registry.redhat.io/multicluster-engine替换为localhost:5000/multicluster-engine,请使用以下示例:

-

示例 1:要将名为

registries:

- mirror: localhost:5000/rhacm2/

source: registry.redhat.io/rhacm2

- mirror: localhost:5000/multicluster-engine

source: registry.redhat.io/multicluster-engine示例 2: 要将源镜像

registry.redhat.io/rhacm2/registration-rhel8-operator替换为localhost:5000/rhacm2-registration-rhel8-operator,请使用以下示例:registries: - mirror: localhost:5000/rhacm2-registration-rhel8-operator source: registry.redhat.io/rhacm2/registration-rhel8-operator

重要: 如果要使用代理注册导入受管集群,您必须创建一个包含镜像 registry 的 KlusterletConfig。请参见以下示例。根据需要替换值:

apiVersion: config.open-cluster-management.io/v1alpha1

kind: KlusterletConfig

metadata:

name: <klusterletconfigName>

spec:

pullSecret:

namespace: <pullSecretNamespace>

name: <pullSecretName>

registries:

- mirror: <mirrored-image-registry-address>

source: <image-registry-address>

- mirror: <mirrored-image-registry-address>

source: <image-registry-address>请参阅使用 代理注册端点导入受管集群 以了解更多信息。

1.7.4.5.1. 导入具有 ManagedClusterImageRegistry的集群

完成以下步骤以导入使用 ManagedClusterImageRegistry 自定义资源定义自定义的集群:

在您要导入集群的命名空间中创建 pull secret。对于这些步骤,namespace 是

myNamespace。$ kubectl create secret docker-registry myPullSecret \ --docker-server=<your-registry-server> \ --docker-username=<my-name> \ --docker-password=<my-password>在您创建的命名空间中创建一个放置。

apiVersion: cluster.open-cluster-management.io/v1beta1 kind: Placement metadata: name: myPlacement namespace: myNamespace spec: clusterSets: - myClusterSet tolerations: - key: "cluster.open-cluster-management.io/unreachable" operator: Exists注: 需要

unreachable容限才能使配置来选择集群。创建一个

ManagedClusterSet资源,并将其绑定到命名空间。apiVersion: cluster.open-cluster-management.io/v1beta2 kind: ManagedClusterSet metadata: name: myClusterSet --- apiVersion: cluster.open-cluster-management.io/v1beta2 kind: ManagedClusterSetBinding metadata: name: myClusterSet namespace: myNamespace spec: clusterSet: myClusterSet在命名空间中创建

ManagedClusterImageRegistry自定义资源定义。apiVersion: imageregistry.open-cluster-management.io/v1alpha1 kind: ManagedClusterImageRegistry metadata: name: myImageRegistry namespace: myNamespace spec: placementRef: group: cluster.open-cluster-management.io resource: placements name: myPlacement pullSecret: name: myPullSecret registry: myRegistryAddress- 从控制台导入受管集群并将其添加到受管集群集中。

-

在将

open-cluster-management.io/image-registry=myNamespace.myImageRegistry标签添加到受管集群后,在受管集群中复制并运行导入命令。

1.7.5. 访问集群

要访问创建并被管理的 Red Hat OpenShift Container Platform 集群,请完成以下步骤:

- 在控制台中,导航到 Infrastructure > Clusters,再选择您创建的或想要访问的集群的名称。

选择 Reveal credentials 来查看集群的用户名和密码。记下这些值以便在登录到集群时使用。

注: Reveal credentials 选项不适用于导入的集群。

- 选择 Console URL 以链接到集群。

- 使用在第 3 步中找到的用户 ID 和密码登录集群。

1.7.6. 扩展受管集群

对于您创建的集群,您可以自定义和调整受管集群规格,如虚拟机大小和节点数量。如果您为集群部署使用安装程序置备的基础架构,请参阅以下选项:

如果您使用中央基础架构管理集群部署,请查看以下选项:

1.7.6.1. 使用 MachinePool 扩展

对于使用 multicluster engine operator 置备的集群,会自动为您创建一个 MachinePool 资源。您可以使用 MachinePool 进一步自定义和调整受管集群规格,如虚拟机大小和节点数。

-

裸机集群不支持使用

MachinePool资源。 -

MachinePool资源是 Hub 集群上的 Kubernetes 资源,用于将MachineSet资源分组到受管集群上。 -

MachinePool资源统一配置一组计算机资源,包括区配置、实例类型和 root 存储。 -

使用

MachinePool,您可以手动配置所需的节点数量,或者配置受管集群中的节点自动扩展。

1.7.6.1.1. 配置自动扩展

配置自动扩展可让集群根据需要进行扩展,从而降低资源成本,在流量较低时进行缩减,并通过向上扩展以确保在资源需求较高时有足够的资源。

要使用控制台在

MachinePool资源上启用自动扩展,请完成以下步骤:- 在导航中,选择 Infrastructure > Clusters。

- 点目标集群的名称并选择 Machine pool 选项卡。

- 在 machine pool 页中,从目标机器池的 Options 菜单中选择 Enable autoscale。

选择机器设置副本的最小和最大数量。计算机集副本直接映射到集群中的节点。

在点 Scale 后,更改可能需要几分钟时间来反映控制台。您可以点 Machine pool 选项卡中的 View machine 来查看扩展操作的状态。

要使用命令行在

MachinePool资源上启用自动扩展,请完成以下步骤:输入以下命令查看您的机器池列表,将

managed-cluster-namespace替换为目标受管集群的命名空间。oc get machinepools -n <managed-cluster-namespace>输入以下命令为机器池编辑 YAML 文件:

oc edit machinepool <MachinePool-resource-name> -n <managed-cluster-namespace>-

将

MachinePool-resource-name替换为MachinePool资源的名称。 -

将

managed-cluster-namespace替换为受管集群的命名空间的名称。

-

将

-

从 YAML 文件删除

spec.replicas字段。 -

在资源 YAML 中添加

spec.autoscaling.minReplicas设置和spec.autoscaling.maxReplicas项。 -

将最小副本数添加到

minReplicas设置。 -

将最大副本数添加到

maxReplicas设置中。 - 保存文件以提交更改。

1.7.6.1.2. 禁用自动扩展

您可以使用控制台或命令行禁用自动扩展。

要使用控制台禁用自动扩展,请完成以下步骤:

- 在导航中,选择 Infrastructure > Clusters。

- 点目标集群的名称并选择 Machine pool 选项卡。

- 在 machine pool 页面中,从目标机器池的 Options 菜单中选择 Disable autoscale。

选择您想要的机器集副本数量。机器集副本直接与集群中的节点映射。

在点 Scale 后,在控制台中显示可能需要几分钟时间。您可以点 Machine pools 选项卡中的通知中的 View machine 来查看扩展的状态。

要使用命令行禁用自动扩展,请完成以下步骤:

输入以下命令查看您的机器池列表: