17.3. 配置 Red Hat Ceph Storage 集群

这个示例步骤演示了如何为容错配置 Red Hat Ceph 存储集群。您可以创建 CRUSH bucket,将对象存储设备(OSD)节点聚合到数据中心,反映您的实际负载、物理安装。另外,您还创建了一个规则,它告知 CRUSH 如何在您的存储池中复制数据。这些步骤会更新由 Ceph 安装创建的默认 CRUSH map。

先决条件

- 已安装 Red Hat Ceph Storage 集群。有关更多信息,请参阅安装 Red Hat Ceph Storage。

- 您应该了解红帽 Ceph 存储如何使用放置组(PG)在池中组织大量数据对象,以及如何计算池中要使用的 PG 数量。如需更多信息,请参阅 放置组(PG)。

- 您应该了解如何设置池中对象副本数。有关更多信息 ,请设置对象副本的数量。

步骤

创建 CRUSH bucket,以组织您的 OSD 节点。bucket 是 OSD 的列表,基于数据中心等物理位置。在 Ceph 中,这些物理位置称为 故障域。

ceph osd crush add-bucket dc1 datacenter ceph osd crush add-bucket dc2 datacenter将 OSD 节点的主机机器移到您创建的数据中心 CRUSH bucket。将主机名

host1-host4替换为您的主机机器的名称。ceph osd crush move host1 datacenter=dc1 ceph osd crush move host2 datacenter=dc1 ceph osd crush move host3 datacenter=dc2 ceph osd crush move host4 datacenter=dc2确保您创建的 CRUSH bucket

是默认CRUSH 树的一部分。ceph osd crush move dc1 root=default ceph osd crush move dc2 root=default创建规则,以映射数据中心内的存储对象副本。这有助于防止数据丢失并使集群在单一数据中心停止时保持运行。

创建规则的命令使用以下语法:

ceph osd crush rule create-replicated <rule-name> <root> <failure-domain> <class>。示例如下所示:ceph osd crush rule create-replicated multi-dc default datacenter hdd注意在前面的命令中,如果存储集群使用固态驱动器(SSD),请指定

ssd而不是hdd(硬盘硬盘)。配置 Ceph 数据和元数据池,以使用您创建的规则。最初,这可能会导致数据回填到由 CRUSH 算法决定的存储目的地。

ceph osd pool set cephfs_data crush_rule multi-dc ceph osd pool set cephfs_metadata crush_rule multi-dc为您的元数据和数据池指定放置组(PG)和 PG 数量。PGP 值应该等于 PG 值。

ceph osd pool set cephfs_metadata pg_num 128 ceph osd pool set cephfs_metadata pgp_num 128 ceph osd pool set cephfs_data pg_num 128 ceph osd pool set cephfs_data pgp_num 128指定数据和元数据池要使用的副本数。

ceph osd pool set cephfs_data min_size 1 ceph osd pool set cephfs_metadata min_size 1 ceph osd pool set cephfs_data size 2 ceph osd pool set cephfs_metadata size 2

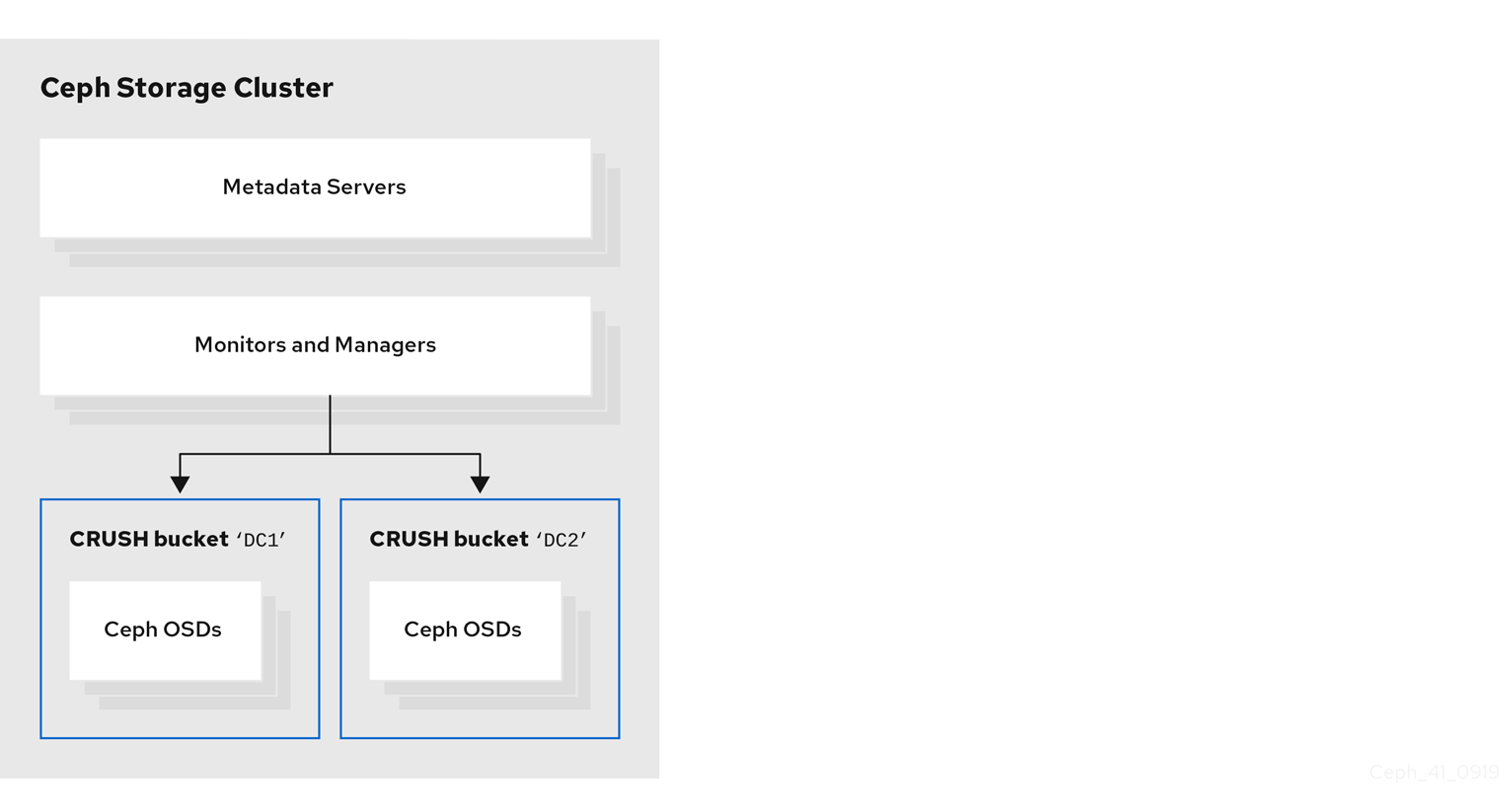

下图显示了上一示例步骤所创建的红帽 Ceph 存储集群。存储群集有 OSD 整理到与数据中心对应的 CRUSH bucket 中。

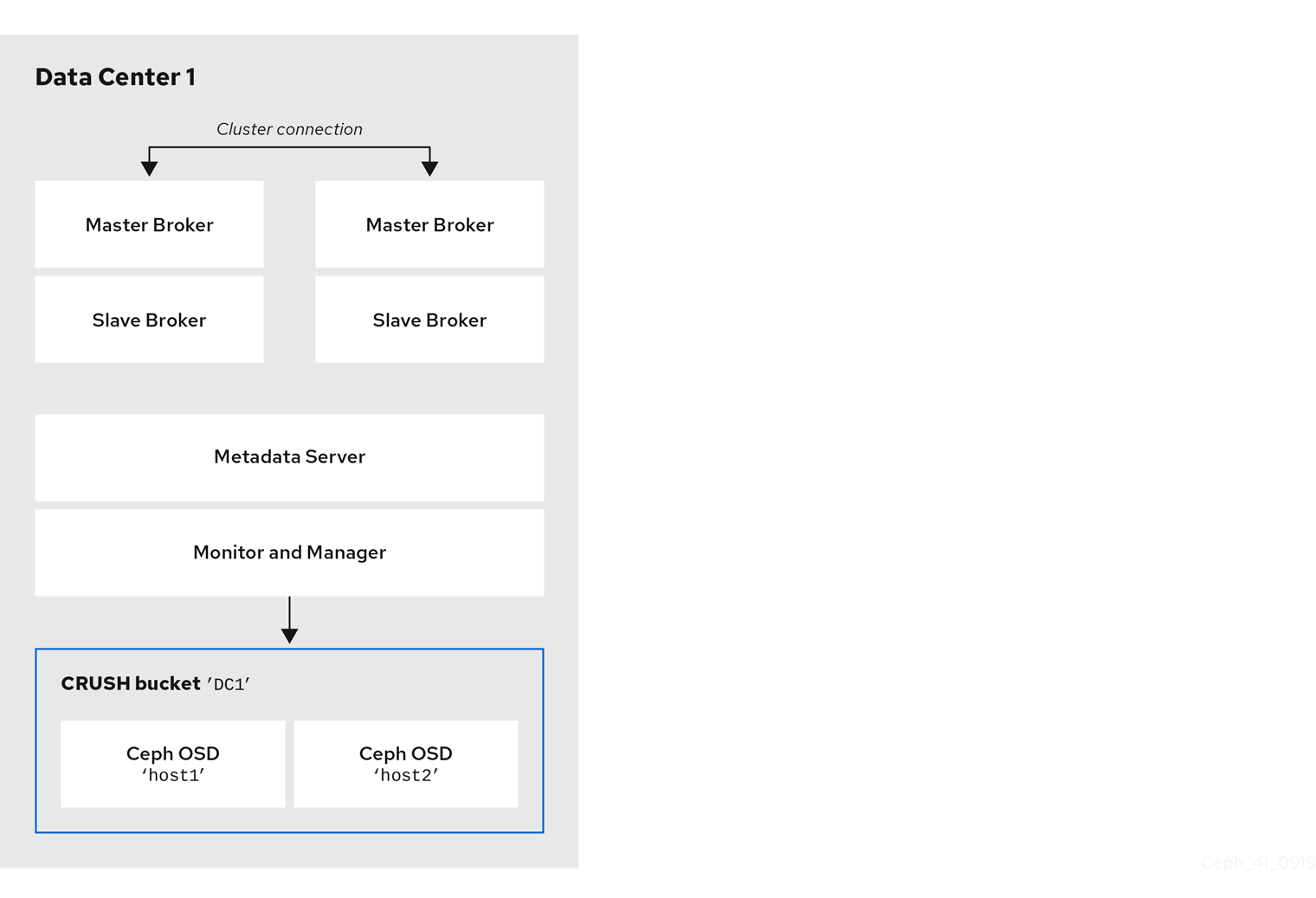

下图显示了第一个数据中心的可能布局,包括您的代理服务器。特别是,数据中心主机:

- 两个 live-backup 代理对的服务器

- 您在前面步骤中分配给第一个数据中心的 OSD 节点

- 单个元数据服务器、监控和管理器节点。monitor 和 Manager 节点通常在同一机器上共存。

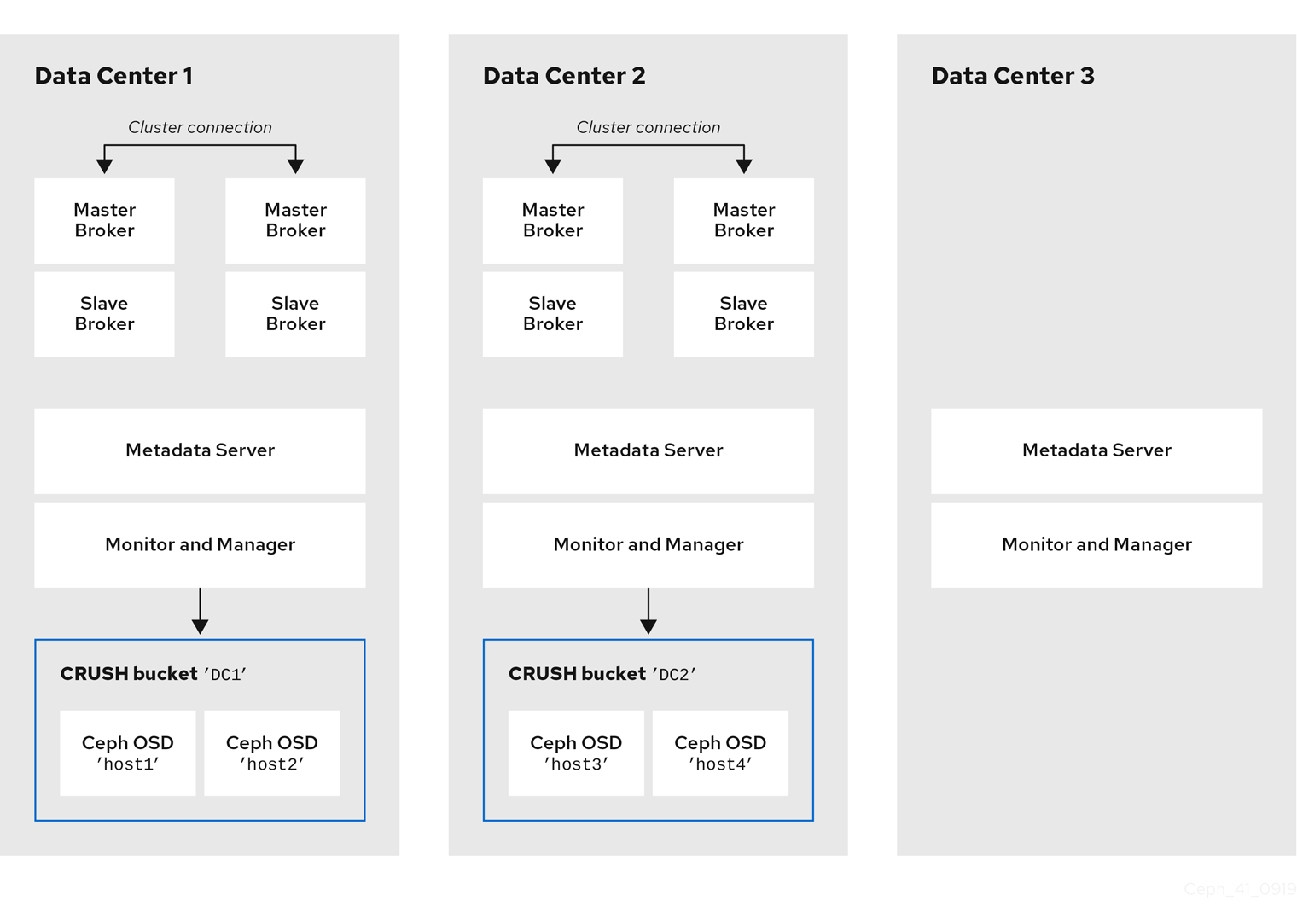

您可以在相同或独立的物理或虚拟机上运行 OSD、MON、MGR 和 MDS 节点。但是,为了确保 Red Hat Ceph Storage 集群中的容错,最好在不同的数据中心分发每种类型的节点。特别是,您必须确保在单个数据中心停机时,存储集群仍具有至少两个可用 MON 节点。因此,如果您在集群中有三个 MON 节点,这些节点必须在单独的数据中心的不同主机上运行。

下图显示了完整的拓扑示例。为确保存储集群中的容错能力,MON、MGR 和 MDS 节点分布到三个不同的数据中心。

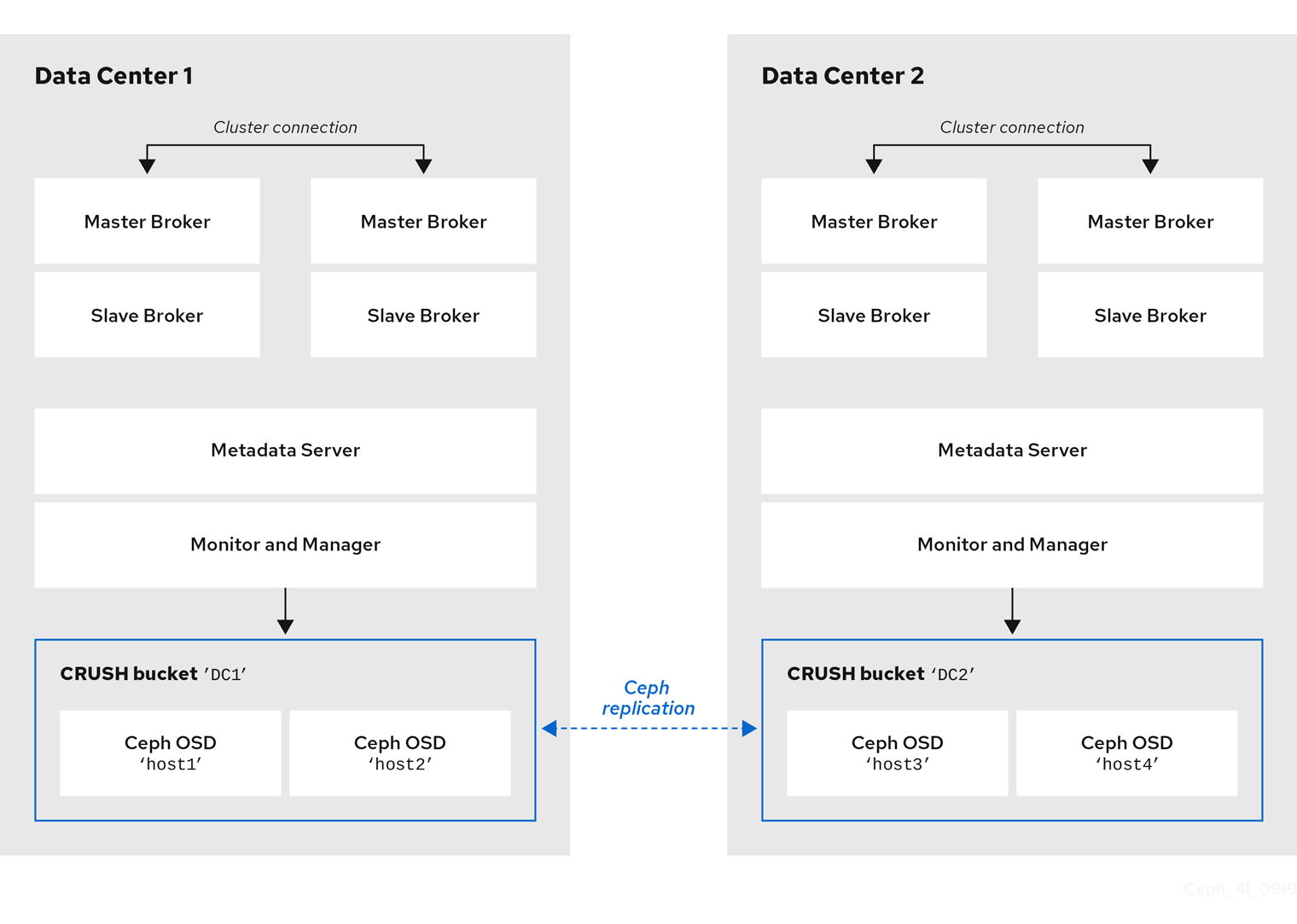

在与代理服务器相同的数据中心中,为某些 OSD 节点定位主机机器并不意味着将消息传递数据存储在那些特定的 OSD 节点上。您可以将代理配置为将消息传递数据存储在 Ceph 文件系统中指定的目录中。然后,您的集群中的元数据服务器节点确定如何在您的数据中心的所有可用 OSD 中分发存储的数据,并在数据中心处理此数据的复制。后续部分显示如何配置代理,将消息传递数据存储在 Ceph 文件系统上。

下图说明了两个有代理服务器的数据中心之间的数据复制。

其他资源

有关以下内容的更多信息: