インストール後の設定

OpenShift Container Platform の Day 2 オペレーション

概要

第1章 インストール後の設定の概要

OpenShift Container Platform のインストール後に、クラスター管理者は以下のコンポーネントを設定し、カスタマイズできます。

- マシン

- ベアメタル

- クラスター

- ノード

- ネットワーク

- ストレージ

- ユーザー

- アラートおよび通知

1.1. インストール後の設定タスク

インストール後の設定タスクを実行して、ニーズに合わせて環境を設定できます。

以下のリストは、これらの設定の詳細です。

-

オペレーティングシステム機能の設定: Machine Config Operator (MCO) は

MachineConfigオブジェクトを管理します。MCO を使用すると、ノードとカスタムリソースを設定できます。 ベアメタルノードの設定: Bare Metal Operator (BMO) を使用してベアメタルホストを管理できます。BMO は次の操作を完了できます。

- ホストのハードウェアの詳細を検査し、ベアメタルホストに報告します。

- ファームウェアを検査し、BIOS を設定します。

- 必要なイメージでホストをプロビジョニングします。

- ホストをプロビジョニングする前または後に、ホストのディスクの内容をクリーンアップします。

クラスター機能の設定: OpenShift Container Platform クラスターの以下の機能を変更できます。

- イメージレジストリー

- ネットワーク設定

- イメージビルドの動作

- アイデンティティープロバイダー

- etcd の設定

- ワークロードを処理するマシンセットの作成

- クラウドプロバイダーの認証情報の管理

プライベートクラスターの設定: デフォルトでは、インストールプログラムはパブリックにアクセス可能な DNS とエンドポイントを使用して、OpenShift Container Platform をプロビジョニングします。内部ネットワーク内からのみクラスターにアクセスできるようにするには、次のコンポーネントを設定してプライベートにします。

- DNS

- Ingress コントローラー

- API サーバー

ノード操作の実施: デフォルトでは、OpenShift Container Platform は Red Hat Enterprise Linux CoreOS (RHCOS) コンピュートマシンを使用します。次のノード操作を実行できます。

- コンピュートマシンの追加および削除

- taint および toleration 追加および削除

- ノードあたりの Pod の最大数の設定

- Device Manager の有効化

- ユーザーの設定: OAuth アクセストークンにより、ユーザーは API に対して認証を行うことができます。次のタスクを実行するように OAuth を設定できます。

- アイデンティティープロバイダーを指定します。

- ロールベースのアクセス制御を使用して、権限を定義し、ユーザーに提供します

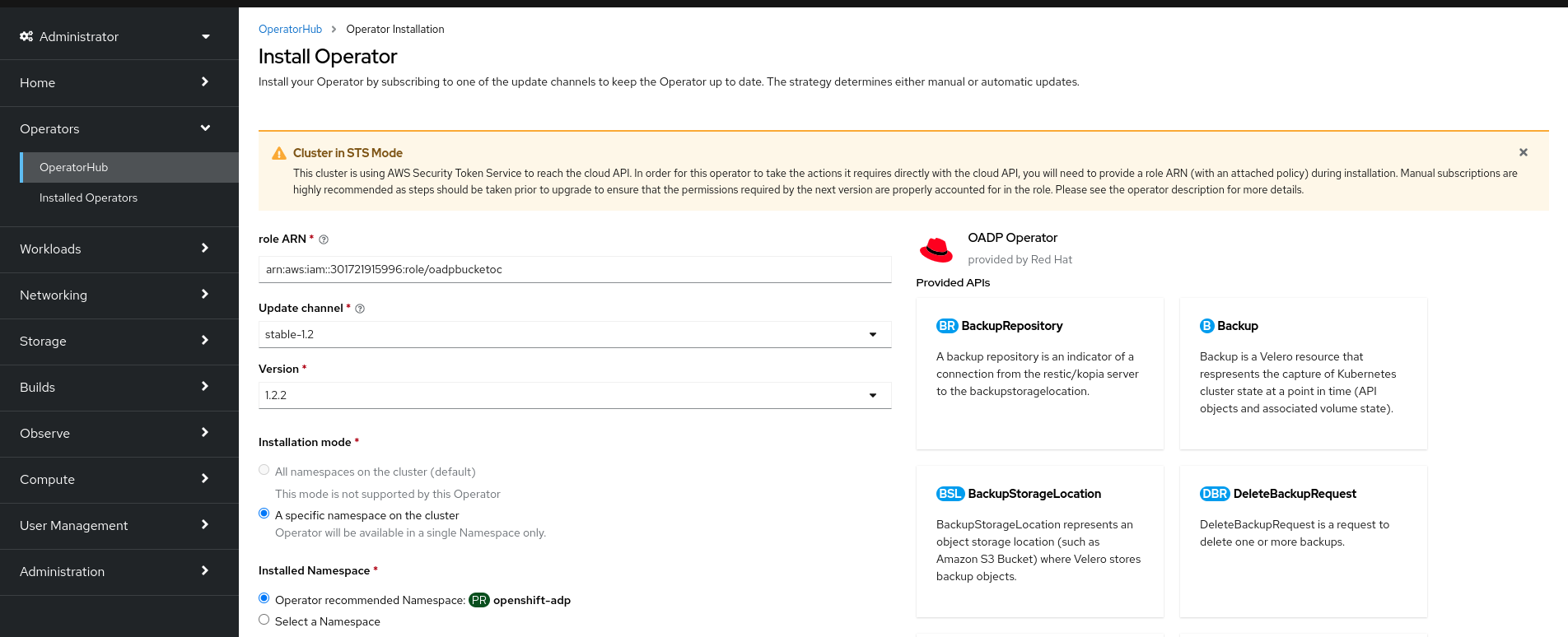

- OperatorHub から Operator をインストールする

- アラート通知の設定: デフォルトでは、アラートの発生は Web コンソールのアラート UI に表示されます。外部システムにアラート通知を送信するように OpenShift Container Platform を設定することもできます。

第2章 プライベートクラスターの設定

OpenShift Container Platform バージョン 4.14 クラスターのインストール後に、そのコアコンポーネントの一部を private に設定できます。

2.1. プライベートクラスター

デフォルトで、OpenShift Container Platform は一般にアクセス可能な DNS およびエンドポイントを使用してプロビジョニングされます。プライベートクラスターのデプロイ後に DNS、Ingress コントローラー、および API サーバーを private に設定できます。

クラスターにパブリックサブネットがある場合、管理者により作成されたロードバランサーサービスはパブリックにアクセスできる可能性があります。クラスターのセキュリティーを確保するには、これらのサービスに明示的にプライベートアノテーションが付けられていることを確認してください。

2.1.1. DNS

OpenShift Container Platform を installer-provisioned infrastructure にインストールする場合、インストールプログラムは既存のパブリックゾーンにレコードを作成し、可能な場合はクラスター独自の DNS 解決用のプライベートゾーンを作成します。パブリックゾーンおよびプライベートゾーンの両方で、インストールプログラムまたはクラスターが Ingress オブジェクトの *.apps、および API サーバーの api の DNS エントリーを作成します。

*.apps レコードはパブリックゾーンとプライベートゾーンのどちらでも同じであるため、パブリックゾーンを削除する際に、プライベートゾーンではクラスターのすべての DNS 解決をシームレスに提供します。

2.1.2. Ingress コントローラー

デフォルトの Ingress オブジェクトはパブリックとして作成されるため、ロードバランサーはインターネットに接続され、パブリックサブネットで使用されます。

Ingress Operator は、カスタムのデフォルト証明書を設定するまで、プレースホルダーとして機能する Ingress コントローラーのデフォルト証明書を生成します。実稼働クラスターで Operator が生成するデフォルト証明書は使用しないでください。Ingress Operator は、独自の署名証明書または生成するデフォルト証明書をローテーションしません。Operator が生成するデフォルト証明書は、設定するカスタムデフォルト証明書のプレースホルダーとして使用されます。

2.1.3. API サーバー

デフォルトでは、インストールプログラムは内部トラフィックと外部トラフィックの両方で使用するための API サーバーの適切なネットワークロードバランサーを作成します。

Amazon Web Services (AWS) では、個別のパブリックロードバランサーおよびプライベートロードバランサーが作成されます。ロードバランサーは、クラスター内で使用するために追加ポートが内部で利用可能な場合を除き、常に同一です。インストールプログラムは API サーバー要件に基づいてロードバランサーを自動的に作成または破棄しますが、クラスターはそれらを管理または維持しません。クラスターの API サーバーへのアクセスを保持する限り、ロードバランサーを手動で変更または移動できます。パブリックロードバランサーの場合、ポート 6443 は開放され、ヘルスチェックが HTTPS について /readyz パスに対して設定されます。

Google Cloud では、内部および外部 API トラフィックの両方を管理するために単一のロードバランサーが作成されるため、ロードバランサーを変更する必要はありません。

Microsoft Azure では、パブリックおよびプライベートロードバランサーの両方が作成されます。ただし、現在の実装には制限があるため、プライベートクラスターで両方のロードバランサーを保持します。

2.2. プライベートゾーンで公開する DNS レコードの設定

すべての OpenShift Container Platform クラスターでは、パブリックかプライベートかにかかわらず、DNS レコードはデフォルトでパブリックゾーンに公開されます。

DNS レコードをパブリックに公開しない場合は、クラスター DNS 設定からパブリックゾーンを削除できます。内部ドメイン名、内部 IP アドレス、組織内のクラスターの数などの機密情報を公開しない場合や、レコードを公開する必要がない場合もあります。クラスター内のサービスに接続できるすべてのクライアントが、プライベートゾーンの DNS レコードを持つプライベート DNS サービスを使用する場合、クラスターのパブリック DNS レコードは必要ありません。

クラスターをデプロイした後、DNS カスタムリソース (CR) を変更して、プライベートゾーンのみを使用するように DNS を変更できます。このように DNS CR を変更すると、その後に作成される DNS レコードはパブリック DNS サーバーに公開されなくなり、DNS レコードに関する情報は内部ユーザーだけに限定されます。これは、クラスターをプライベートに設定する場合、または DNS レコードをパブリックに解決する必要がない場合に適用できます。

または、プライベートクラスターでも DNS レコード用のパブリックゾーンを保持し、クライアントがそのクラスターで実行されているアプリケーションの DNS 名を解決できるようにすることも可能です。たとえば組織は、パブリックインターネットに接続するマシンを所有し、特定のプライベート IP 範囲に対して VPN 接続を確立してプライベート IP アドレスに接続することができます。これらのマシンからの DNS ルックアップでは、パブリック DNS を使用してそれらのサービスのプライベートアドレスを判断し、VPN 経由でプライベートアドレスに接続します。

手順

次のコマンドを実行して出力を確認し、クラスターの

DNSCR を確認します。$ oc get dnses.config.openshift.io/cluster -o yaml出力例

apiVersion: config.openshift.io/v1 kind: DNS metadata: creationTimestamp: "2019-10-25T18:27:09Z" generation: 2 name: cluster resourceVersion: "37966" selfLink: /apis/config.openshift.io/v1/dnses/cluster uid: 0e714746-f755-11f9-9cb1-02ff55d8f976 spec: baseDomain: <base_domain> privateZone: tags: Name: <infrastructure_id>-int kubernetes.io/cluster/<infrastructure_id>: owned publicZone: id: Z2XXXXXXXXXXA4 status: {}specセクションには、プライベートゾーンとパブリックゾーンの両方が含まれることに注意してください。次のコマンドを実行して、

DNSCR にパッチを適用し、パブリックゾーンを削除します。$ oc patch dnses.config.openshift.io/cluster --type=merge --patch='{"spec": {"publicZone": null}}'出力例

dns.config.openshift.io/cluster patchedIngress Operator は、

IngressControllerオブジェクトの DNS レコード作成時にDNSCR 定義を参照します。プライベートゾーンのみ指定されている場合、プライベートレコードのみが作成されます。重要パブリックゾーンを削除しても、既存の DNS レコードは変更されません。以前に公開したパブリック DNS レコードで、パブリックに公開する必要がなくなったものは、手動で削除する必要があります。

検証

次のコマンドを実行し、出力でクラスターの

DNSCR を確認してパブリックゾーンが削除されたことを確認します。$ oc get dnses.config.openshift.io/cluster -o yaml出力例

apiVersion: config.openshift.io/v1 kind: DNS metadata: creationTimestamp: "2019-10-25T18:27:09Z" generation: 2 name: cluster resourceVersion: "37966" selfLink: /apis/config.openshift.io/v1/dnses/cluster uid: 0e714746-f755-11f9-9cb1-02ff55d8f976 spec: baseDomain: <base_domain> privateZone: tags: Name: <infrastructure_id>-int kubernetes.io/cluster/<infrastructure_id>-wfpg4: owned status: {}

2.3. Ingress コントローラーをプライベートに設定する

クラスターのデプロイ後に、その Ingress コントローラーをプライベートゾーンのみを使用するように変更できます。

手順

内部エンドポイントのみを使用するようにデフォルト Ingress コントローラーを変更します。

$ oc replace --force --wait --filename - <<EOF apiVersion: operator.openshift.io/v1 kind: IngressController metadata: namespace: openshift-ingress-operator name: default spec: endpointPublishingStrategy: type: LoadBalancerService loadBalancer: scope: Internal EOF出力例

ingresscontroller.operator.openshift.io "default" deleted ingresscontroller.operator.openshift.io/default replacedパブリック DNS エントリーが削除され、プライベートゾーンエントリーが更新されます。

2.4. API サーバーをプライベートに制限する

クラスターを Amazon Web Services (AWS) または Microsoft Azure にデプロイした後に、プライベートゾーンのみを使用するように API サーバーを再設定することができます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

admin権限を持つユーザーとして Web コンソールにアクセスできること。

手順

クラウドプロバイダーの Web ポータルまたはコンソールで、次の操作を行います。

適切なロードバランサーコンポーネントを見つけて削除します。

- AWS の場合は、外部ロードバランサーを削除します。プライベートゾーンの API DNS エントリーは、同一の設定を使用する内部ロードバランサーをすでに参照するため、内部ロードバランサーを変更する必要はありません。

-

Azure の場合、ロードバランサーの

api-internalルールを削除します。

-

パブリックゾーンの

api.$clustername.$yourdomainDNS エントリーを削除します。

外部ロードバランサーを削除します。

重要以下の手順は、installer-provisioned infrastructure (IPI) のクラスターでのみ実行できます。user-provisioned infrastructure (UPI) のクラスターの場合は、外部ロードバランサーを手動で削除するか、無効にする必要があります。

クラスターでコントロールプレーンマシンセットを使用している場合は、コントロールプレーンマシンセットのカスタムリソースで次の行を削除します。

providerSpec: value: loadBalancers: - name: lk4pj-ext1 type: network2 - name: lk4pj-int type: networkクラスターがコントロールプレーンマシンセットを使用しない場合は、各コントロールプレーンマシンから外部ロードバランサーを削除する必要があります。

ターミナルから、次のコマンドを実行してクラスターマシンを一覧表示します。

$ oc get machine -n openshift-machine-api出力例

NAME STATE TYPE REGION ZONE AGE lk4pj-master-0 running m4.xlarge us-east-1 us-east-1a 17m lk4pj-master-1 running m4.xlarge us-east-1 us-east-1b 17m lk4pj-master-2 running m4.xlarge us-east-1 us-east-1a 17m lk4pj-worker-us-east-1a-5fzfj running m4.xlarge us-east-1 us-east-1a 15m lk4pj-worker-us-east-1a-vbghs running m4.xlarge us-east-1 us-east-1a 15m lk4pj-worker-us-east-1b-zgpzg running m4.xlarge us-east-1 us-east-1b 15mコントロールプレーンマシンの名前には

masterが含まれています。各コントロールプレーンマシンから外部ロードバランサーを削除します。

次のコマンドを実行して、コントロールプレーンマシンオブジェクトを編集します。

$ oc edit machines -n openshift-machine-api <control_plane_name>1 - 1

- 変更するコントロールプレーンマシンオブジェクトの名前を指定します。

次の例でマークされている、外部ロードバランサーを説明する行を削除します。

providerSpec: value: loadBalancers: - name: lk4pj-ext1 type: network2 - name: lk4pj-int type: network- 変更を保存して、オブジェクト仕様を終了します。

- コントロールプレーンマシンごとに、このプロセスを繰り返します。

第3章 ベアメタルの設定

ベアメタルホストに OpenShift Container Platform をデプロイする場合、プロビジョニングの前後にホストに変更を加える必要がある場合があります。これには、ホストのハードウェア、ファームウェア、ファームウェアの詳細の検証が含まれます。また、ディスクのフォーマットや、変更可能なファームウェア設定の変更も含まれます。

3.1. Bare Metal Operator について

Bare Metal Operator (BMO) を使用して、クラスター内のベアメタルホストをプロビジョニング、管理、検査します。

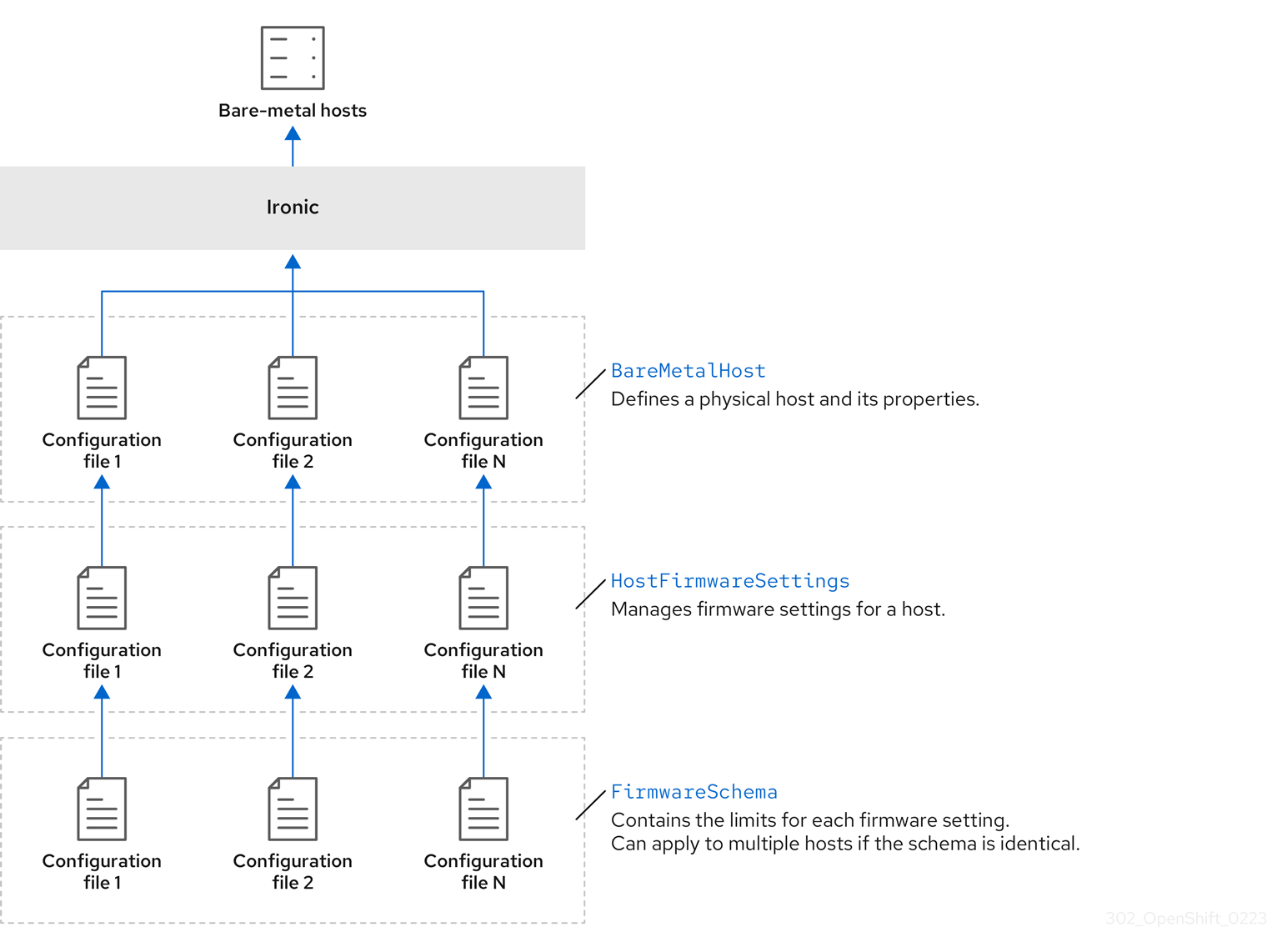

BMO は、次の 3 つのリソースを使用してこれらのタスクを完了します。

-

BareMetalHost -

HostFirmwareSettings -

FirmwareSchema

BMO は、各ベアメタルホストを BareMetalHost カスタムリソース定義のインスタンスにマッピングすることにより、クラスター内の物理ホストのインベントリーを維持します。各 BareMetalHost リソースには、ハードウェア、ソフトウェア、およびファームウェアの詳細が含まれています。BMO は、クラスター内のベアメタルホストを継続的に検査して、各 BareMetalHost リソースが対応するホストのコンポーネントを正確に詳述していることを確認します。

BMO はまた、HostFirmwareSettings リソースと FirmwareSchema リソースを使用して、ベアメタルホストのファームウェア仕様を詳述します。

BMO は、Ironic API サービスを使用してクラスター内のベアメタルホストと接続します。Ironic サービスは、ホスト上のベースボード管理コントローラー (BMC) を使用して、マシンと接続します。

BMO を使用して実行できる一般的なタスクには、次のようなものがあります。

- 特定のイメージを使用したクラスターへのベアメタルホストのプロビジョニング

- プロビジョニング前またはプロビジョニング解除後におけるホストのディスクコンテンツのフォーマット

- ホストのオン/オフの切り替え

- ファームウェア設定の変更

- ホストのハードウェア詳細の表示

3.1.1. Bare Metal Operator のアーキテクチャー

Bare Metal Operator (BMO) は、3 つのリソースを使用して、クラスター内のベアメタルホストをプロビジョニング、管理、検査します。次の図は、これらのリソースのアーキテクチャーを示しています。

BareMetalHost

BareMetalHost リソースは、物理ホストとそのプロパティーを定義します。ベアメタルホストをクラスターにプロビジョニングするときは、そのホストの BareMetalHost リソースを定義する必要があります。ホストの継続的な管理のために、BareMetalHost の情報を調べたり、この情報を更新したりできます。

BareMetalHost リソースには、次のようなプロビジョニング情報が含まれます。

- オペレーティングシステムのブートイメージやカスタム RAM ディスクなどのデプロイメント仕様

- プロビジョニング状態

- ベースボード管理コントローラー (BMC) アドレス

- 目的の電源状態

BareMetalHost リソースには、次のようなハードウェア情報が含まれます。

- CPU 数

- NIC の MAC アドレス

- ホストのストレージデバイスのサイズ

- 現在の電源状態

HostFirmwareSettings

HostFirmwareSettings リソースを使用して、ホストのファームウェア設定を取得および管理できます。ホストが Available 状態に移行すると、Ironic サービスはホストのファームウェア設定を読み取り、HostFirmwareSettings リソースを作成します。BareMetalHost リソースと HostFirmwareSettings リソースの間には 1 対 1 のマッピングがあります。

HostFirmwareSettings リソースを使用して、ホストのファームウェア仕様を調べたり、ホストのファームウェア仕様を更新したりできます。

HostFirmwareSettings リソースの spec フィールドを編集するときは、ベンダーファームウェアに固有のスキーマに従う必要があります。このスキーマは、読み取り専用の FirmwareSchema リソースで定義されます。

FirmwareSchema

ファームウェア設定は、ハードウェアベンダーやホストモデルによって異なります。FirmwareSchema リソースは、各ホストモデル上の各ファームウェア設定のタイプおよび制限が含まれる読み取り専用リソースです。データは、Ironic サービスを使用して BMC から直接取得されます。FirmwareSchema リソースを使用すると、HostFirmwareSettings リソースの spec フィールドに指定できる有効な値を特定できます。

スキーマが同じであれば、FirmwareSchema リソースは多くの BareMetalHost リソースに適用できます。

3.2. BareMetalHost リソースについて

Metal3 で、物理ホストとそのプロパティーを定義する BareMetalHost リソースの概念が導入されました。BareMetalHost リソースには、2 つのセクションが含まれます。

-

BareMetalHostspec -

BareMetalHoststatus

3.2.1. BareMetalHost spec

BareMetalHost リソースの spec セクションは、ホストの必要な状態を定義します。

| パラメーター | 説明 |

|---|---|

|

|

プロビジョニングおよびプロビジョニング解除時の自動クリーニングを有効または無効にするインターフェイス。 |

|

|

|

| ホストのプロビジョニングに使用する NIC の MAC アドレス。 |

|

|

ホストのブートモード。デフォルトは |

|

|

ホストを使用している別のリソースへの参照。別のリソースが現在ホストを使用していない場合は、空になることがあります。たとえば、 |

|

| ホストの特定に役立つ、人間が提供した文字列。 |

|

| ホストのプロビジョニングとプロビジョニング解除が外部で管理されるかどうかを示すブール値。設定される場合:

|

|

|

ベアメタルホストの BIOS 設定に関する情報が含まれます。現在、

|

|

|

|

| ネットワーク設定データおよびその namespace が含まれるシークレットへの参照。したがって、ホストが起動してネットワークをセットアップする前にホストに接続することができます。 |

|

|

ホストの電源を入れる ( |

| (オプション) ベアメタルホストの RAID 設定に関する情報が含まれます。指定しない場合は、現在の設定を保持します。 注記 OpenShift Container Platform 4.14 は、iRMC プロトコルのみを使用して BMC のハードウェア RAID をサポートします。OpenShift Container Platform 4.20 は、インストールドライブ上のソフトウェア RAID をサポートしていません。 次の構成設定を参照してください。

ドライバーが RAID に対応していないことを示すエラーメッセージが表示された場合は、 |

|

|

3.2.2. BareMetalHost status

BareMetalHost status は、ホストの現在の状態を表し、テスト済みの認証情報、現在のハードウェアの詳細などの情報が含まれます。

| パラメーター | 説明 |

|---|---|

|

| シークレットおよびその namespace の参照で、システムが動作中と検証できるベースボード管理コントローラー (BMC) 認証情報のセットが保持されています。 |

|

| プロビジョニングバックエンドが報告する最後のエラーの詳細 (ある場合)。 |

|

| ホストがエラー状態になった原因となった問題のクラスを示します。エラータイプは以下のとおりです。

|

|

|

| BIOS ファームウェア情報が含まれます。たとえば、ハードウェアベンダーおよびバージョンなどです。 |

|

|

| ホストのメモリー容量 (MiB 単位)。 |

|

|

|

ホストの |

|

| ホストのステータスの最終更新時のタイムスタンプ。 |

|

| サーバーのステータス。ステータスは以下のいずれかになります。

|

|

| ホストの電源が入っているかどうかを示すブール値。 |

|

|

|

| プロビジョニングバックエンドに送信された BMC 認証情報の最後のセットを保持するシークレットおよびその namespace への参照。 |

3.3. BareMetalHost リソースの取得

BareMetalHost リソースには、物理ホストのプロパティーが含まれます。物理ホストのプロパティーをチェックするには、その BareMetalHost リソースを取得する必要があります。

手順

BareMetalHostリソースの一覧を取得します。$ oc get bmh -n openshift-machine-api -o yaml注記oc getコマンドで、bmhの長い形式として、baremetalhostを使用できます。ホストのリストを取得します。

$ oc get bmh -n openshift-machine-api特定のホストの

BareMetalHostリソースを取得します。$ oc get bmh <host_name> -n openshift-machine-api -o yamlここで、

<host_name>はホストの名前です。出力例

apiVersion: metal3.io/v1alpha1 kind: BareMetalHost metadata: creationTimestamp: "2022-06-16T10:48:33Z" finalizers: - baremetalhost.metal3.io generation: 2 name: openshift-worker-0 namespace: openshift-machine-api resourceVersion: "30099" uid: 1513ae9b-e092-409d-be1b-ad08edeb1271 spec: automatedCleaningMode: metadata bmc: address: redfish://10.46.61.19:443/redfish/v1/Systems/1 credentialsName: openshift-worker-0-bmc-secret disableCertificateVerification: true bootMACAddress: 48:df:37:c7:f7:b0 bootMode: UEFI consumerRef: apiVersion: machine.openshift.io/v1beta1 kind: Machine name: ocp-edge-958fk-worker-0-nrfcg namespace: openshift-machine-api customDeploy: method: install_coreos online: true rootDeviceHints: deviceName: /dev/disk/by-id/scsi-<serial_number> userData: name: worker-user-data-managed namespace: openshift-machine-api status: errorCount: 0 errorMessage: "" goodCredentials: credentials: name: openshift-worker-0-bmc-secret namespace: openshift-machine-api credentialsVersion: "16120" hardware: cpu: arch: x86_64 clockMegahertz: 2300 count: 64 flags: - 3dnowprefetch - abm - acpi - adx - aes model: Intel(R) Xeon(R) Gold 5218 CPU @ 2.30GHz firmware: bios: date: 10/26/2020 vendor: HPE version: U30 hostname: openshift-worker-0 nics: - mac: 48:df:37:c7:f7:b3 model: 0x8086 0x1572 name: ens1f3 ramMebibytes: 262144 storage: - hctl: "0:0:0:0" model: VK000960GWTTB name: /dev/disk/by-id/scsi-<serial_number> sizeBytes: 960197124096 type: SSD vendor: ATA systemVendor: manufacturer: HPE productName: ProLiant DL380 Gen10 (868703-B21) serialNumber: CZ200606M3 lastUpdated: "2022-06-16T11:41:42Z" operationalStatus: OK poweredOn: true provisioning: ID: 217baa14-cfcf-4196-b764-744e184a3413 bootMode: UEFI customDeploy: method: install_coreos image: url: "" raid: hardwareRAIDVolumes: null softwareRAIDVolumes: [] rootDeviceHints: deviceName: /dev/disk/by-id/scsi-<serial_number> state: provisioned triedCredentials: credentials: name: openshift-worker-0-bmc-secret namespace: openshift-machine-api credentialsVersion: "16120"

3.4. HostFirmwareSettings リソースについて

HostFirmwareSettings リソースを使用して、ホストの BIOS 設定を取得および管理できます。ホストが Available 状態に移行すると、Ironic はホストの BIOS 設定を読み取り、HostFirmwareSettings リソースを作成します。リソースには、ベースボード管理コントローラー (BMC) から返される完全な BIOS 設定が含まれます。BareMetalHost リソースの firmware フィールドは、ベンダーに依存しない 3 つのフィールドを返しますが、HostFirmwareSettings リソースは、通常ホストごとにベンダー固有のフィールドの多数の BIOS 設定で構成されます。

HostFirmwareSettings リソースには、以下の 2 つのセクションが含まれます。

-

HostFirmwareSettingsspec -

HostFirmwareSettingsstatus

3.4.1. HostFirmwareSettings spec

HostFirmwareSettings リソースの spec セクションは、ホストの BIOS の必要な状態を定義し、デフォルトでは空です。Ironic は spec.settings セクションの設定を使用して、ホストが Preparing 状態の場合、ベースボード管理コントローラー (BMC) を更新します。FirmwareSchema リソースを使用して、無効な名前と値のペアをホストに送信しないようにします。詳細は、「FirmwareSchema リソースについて」を参照してください。

例

spec:

settings:

ProcTurboMode: Disabled- 1

- 前述の例では、

spec.settingsセクションには、ProcTurboModeBIOS 設定をDisabledに設定する名前/値のペアが含まれます。

status セクションに一覧表示される整数パラメーターは文字列として表示されます。たとえば、"1" と表示されます。spec.settings セクションで整数を設定する場合、値は引用符なしの整数として設定する必要があります。たとえば、1 と設定します。

3.4.2. HostFirmwareSettings status

status は、ホストの BIOS の現在の状態を表します。

| パラメーター | 説明 |

|---|---|

|

|

|

ファームウェア設定の

|

|

|

3.5. HostFirmwareSettings リソースの取得

HostFirmwareSettings リソースには、物理ホストのベンダー固有の BIOS プロパティーが含まれます。物理ホストの BIOS プロパティーをチェックするには、その HostFirmwareSettings リソースを取得する必要があります。

手順

HostFirmwareSettingsリソースの詳細な一覧を取得します。$ oc get hfs -n openshift-machine-api -o yaml注記oc getコマンドで、hfsの長い形式として、hostfirmwaresettingsを使用できます。HostFirmwareSettingsリソースの一覧を取得します。$ oc get hfs -n openshift-machine-api特定のホストの

HostFirmwareSettingsリソースを取得します。$ oc get hfs <host_name> -n openshift-machine-api -o yamlここで、

<host_name>はホストの名前です。

3.6. HostFirmwareSettings リソースの編集

プロビジョニングされたホストの HostFirmwareSettings を編集できます。

読み取り専用の値を除き、ホストが プロビジョニング された状態にある場合にのみ、ホストを編集できます。externally provisioned 状態のホストは編集できません。

手順

HostFirmwareSettingsリソースの一覧を取得します。$ oc get hfs -n openshift-machine-apiホストの

HostFirmwareSettingsリソースを編集します。$ oc edit hfs <host_name> -n openshift-machine-apiここで、

<host_name>はプロビジョニングされたホストの名前です。HostFirmwareSettingsリソースは、ターミナルのデフォルトエディターで開きます。spec.settingsセクションに、名前と値のペアを追加します。例

spec: settings: name: value1 - 1

FirmwareSchemaリソースを使用して、ホストで利用可能な設定を特定します。読み取り専用の値は設定できません。

- 変更を保存し、エディターを終了します。

ホストのマシン名を取得します。

$ oc get bmh <host_name> -n openshift-machine nameここで、

<host_name>はホストの名前です。マシン名はCONSUMERフィールドの下に表示されます。マシンにアノテーションを付け、マシンセットから削除します。

$ oc annotate machine <machine_name> machine.openshift.io/delete-machine=true -n openshift-machine-apiここで、

<machine_name>は削除するマシンの名前です。ノードのリストを取得し、ワーカーノードの数をカウントします。

$ oc get nodesマシンセットを取得します。

$ oc get machinesets -n openshift-machine-apiマシンセットをスケーリングします。

$ oc scale machineset <machineset_name> -n openshift-machine-api --replicas=<n-1>ここで、

<machineset_name>はマシンセットの名前で、<n-1>は減少させたワーカーノードの数です。ホストが

Availableの状態になったら、machineset をスケールアップして、HostFirmwareSettingsリソースの変更を反映させます。$ oc scale machineset <machineset_name> -n openshift-machine-api --replicas=<n>ここで、

<machineset_name>はマシンセットの名前で、<n>はワーカーノードの数です。

3.7. HostFirmware Settings リソースが有効であることの確認

ユーザーが spec.settings セクションを編集して HostFirmwareSetting (HFS) リソースに変更を加えると、Bare Metal Operator (BMO) は読み取り専用リソースである FimwareSchema リソースに対して変更を検証します。この設定が無効な場合、BMO は status.Condition 設定の Type の値を False に設定し、イベントを生成して HFS リソースに保存します。以下の手順を使用して、リソースが有効であることを確認します。

手順

HostFirmwareSettingリソースの一覧を取得します。$ oc get hfs -n openshift-machine-api特定のホストの

HostFirmwareSettingsリソースが有効であることを確認します。$ oc describe hfs <host_name> -n openshift-machine-apiここで、

<host_name>はホストの名前です。出力例

Events: Type Reason Age From Message ---- ------ ---- ---- ------- Normal ValidationFailed 2m49s metal3-hostfirmwaresettings-controller Invalid BIOS setting: Setting ProcTurboMode is invalid, unknown enumeration value - Foo重要応答が

ValidationFailedを返す場合、リソース設定にエラーがあり、FirmwareSchemaリソースに準拠するよう値を更新する必要があります。

3.8. FirmwareSchema リソースについて

BIOS 設定は、ハードウェアベンダーやホストモデルによって異なります。FirmwareSchema リソースは、各ホストモデル上の各 BIOS 設定のタイプおよび制限が含まれる読み取り専用リソースです。データは BMC から Ironic に直接取得されます。FirmwareSchema を使用すると、HostFirmwareSettings リソースの spec フィールドに指定できる有効な値を特定できます。FirmwareSchema リソースには、その設定および制限から派生する一意の識別子があります。同じホストモデルは同じ FirmwareSchema 識別子を使用します。HostFirmwareSettings の複数のインスタンスが同じ FirmwareSchema を使用する可能性が高いです。

| パラメーター | 説明 |

|---|---|

|

|

3.9. FirmwareSchema リソースの取得

各ベンダーの各ホストモデルの BIOS 設定は、それぞれ異なります。HostFirmwareSettings リソースの spec セクションを編集する際に、設定する名前/値のペアはそのホストのファームウェアスキーマに準拠している必要があります。有効な名前と値のペアを設定するには、ホストの FirmwareSchema を取得して確認します。

手順

FirmwareSchemaリソースインスタンスの一覧を取得するには、以下を実行します。$ oc get firmwareschema -n openshift-machine-api特定の

FirmwareSchemaインスタンスを取得するには、以下を実行します。$ oc get firmwareschema <instance_name> -n openshift-machine-api -o yamlここで、

<instance_name>は、HostFirmwareSettingsリソース (表 3 を参照) に記載されているスキーマインスタンスの名前です。

第4章 OpenShift クラスターでのマルチアーキテクチャーのコンピュートマシンの設定

4.1. マルチアーキテクチャーのコンピュートマシンを含むクラスターについて

マルチアーキテクチャー計算マシンを使用する OpenShift Container Platform クラスターは、異なるアーキテクチャーのコンピュートマシンをサポートするクラスターです。マルチアーキテクチャーのコンピュートマシンを備えたクラスターは、Amazon Web Services (AWS) または Microsoft Azure インストーラーによってプロビジョニングされたインフラストラクチャーと、x86_64 コントロールプレーンマシンを備えたベアメタル、IBM Power®、および IBM Z® ユーザーによってプロビジョニングされたインフラストラクチャーでのみ使用できます。

クラスター内に複数のアーキテクチャーを持つノードがある場合、イメージのアーキテクチャーはノードのアーキテクチャーと一致している必要があります。Pod が適切なアーキテクチャーを持つノードに割り当てられていること、およびそれがイメージアーキテクチャーと一致していることを確認する必要があります。ノードへの Pod の割り当ての詳細は、ノードへの Pod の割り当て を参照してください。

Cluster Samples Operator は、マルチアーキテクチャーのコンピューティングマシンを含むクラスターではサポートされません。この機能がなくてもクラスターを作成できます。詳細は、クラスター機能の有効化 を参照してください。

シングルアーキテクチャーのクラスターを、マルチアーキテクチャーのコンピュートマシンをサポートするクラスターに移行する方法は、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 を参照してください。

4.1.1. マルチアーキテクチャーのコンピュートマシンを使用したクラスターの設定

さまざまなプラットフォーム用のマルチアーキテクチャーコンピュートマシンを含むクラスターを作成するには、次のセクションのドキュメントを使用できます。

- Azure 上でマルチアーキテクチャーのコンピューティングマシンを含むクラスターを作成する

- AWS 上でマルチアーキテクチャーのコンピューティングマシンを含むクラスターを作成する

- Google Cloud でマルチアーキテクチャーのコンピューティングマシンを含むクラスターを作成する

- ベアメタル上でマルチアーキテクチャーのコンピューティングマシンを含むクラスターを作成する

- z/VM を使用した IBM Z® および IBM® LinuxONE 上のマルチアーキテクチャーコンピュートマシンを含むクラスターの作成

- RHEL KVM を使用した IBM Z® および IBM® LinuxONE 上のマルチアーキテクチャーコンピュートマシンを含むクラスターの作成

- IBM Power® 上のマルチアーキテクチャーコンピュートマシンを含むクラスターの作成

現在、ゼロからの自動スケーリングは Google Cloud ではサポートされていません。

4.2. Azure でマルチアーキテクチャーコンピューティングマシンを使用したクラスターを作成する

マルチアーキテクチャーコンピューティングマシンを使用して Azure クラスターをデプロイするには、まず、マルチアーキテクチャーインストーラーバイナリーを使用する単一アーキテクチャーの Azure インストーラープロビジョニングクラスターを作成する必要があります。Azure へのインストールの詳細は、カスタマイズを使用した Azure へのクラスターのインストール を参照してください。その後、ARM64 コンピューティングマシンセットをクラスターに追加して、マルチアーキテクチャーコンピューティングマシンを含むクラスターを作成できます。

次の手順では、ARM64 ブートイメージを生成し、ARM64 ブートイメージを使用する Azure コンピューティングマシンセットを作成する方法について説明します。これにより、ARM64 コンピュートノードがクラスターに追加され、必要な量の ARM64 仮想マシン (VM) がデプロイされます。

4.2.1. クラスターの互換性の確認

異なるアーキテクチャーのコンピュートノードをクラスターに追加する前に、クラスターがマルチアーキテクチャー互換であることを確認する必要があります。

前提条件

-

OpenShift CLI (

oc) がインストールされている。

手順

次のコマンドを実行すると、クラスターがアーキテクチャーペイロードを使用していることを確認できます。

$ oc adm release info -o jsonpath="{ .metadata.metadata}"

検証

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用しています。

{ "release.openshift.io/architecture": "multi", "url": "https://access.redhat.com/errata/<errata_version>" }その後、クラスターへのマルチアーキテクチャーコンピュートノードの追加を開始できます。

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用していません。

{ "url": "https://access.redhat.com/errata/<errata_version>" }重要クラスターを、マルチアーキテクチャーコンピュートマシンをサポートするクラスターに移行するには、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 の手順に従ってください。

4.2.2. Azure イメージギャラリーを使用した ARM64 ブートイメージの作成

次の手順では、ARM64 ブートイメージを手動で生成する方法について説明します。

前提条件

-

Azure CLI (

az) をインストールしている。 - マルチアーキテクチャーインストーラーバイナリーを使用して、単一アーキテクチャーの Azure インストーラープロビジョニングクラスターを作成している。

手順

Azure アカウントにログインします。

$ az loginストレージアカウントを作成し、

arm64仮想ハードディスク (VHD) をストレージアカウントにアップロードします。OpenShift Container Platform インストールプログラムはリソースグループを作成しますが、ブートイメージをカスタムの名前付きリソースグループにアップロードすることもできます。$ az storage account create -n ${STORAGE_ACCOUNT_NAME} -g ${RESOURCE_GROUP} -l westus --sku Standard_LRS1 - 1

westusオブジェクトはリージョンの例です。

生成したストレージアカウントを使用してストレージコンテナーを作成します。

$ az storage container create -n ${CONTAINER_NAME} --account-name ${STORAGE_ACCOUNT_NAME}URL と

aarch64VHD 名を抽出するには、OpenShift Container Platform インストールプログラムの JSON ファイルを使用する必要があります。次のコマンドを実行して、

URLフィールドを抽出し、ファイル名としてRHCOS_VHD_ORIGIN_URLに設定します。$ RHCOS_VHD_ORIGIN_URL=$(oc -n openshift-machine-config-operator get configmap/coreos-bootimages -o jsonpath='{.data.stream}' | jq -r '.architectures.aarch64."rhel-coreos-extensions"."azure-disk".url')次のコマンドを実行して、

aarch64VHD 名を抽出し、ファイル名としてBLOB_NAMEに設定します。$ BLOB_NAME=rhcos-$(oc -n openshift-machine-config-operator get configmap/coreos-bootimages -o jsonpath='{.data.stream}' | jq -r '.architectures.aarch64."rhel-coreos-extensions"."azure-disk".release')-azure.aarch64.vhd

Shared Access Signature (SAS) トークンを生成します。このトークンを使用して、次のコマンドで RHCOS VHD をストレージコンテナーにアップロードします。

$ end=`date -u -d "30 minutes" '+%Y-%m-%dT%H:%MZ'`$ sas=`az storage container generate-sas -n ${CONTAINER_NAME} --account-name ${STORAGE_ACCOUNT_NAME} --https-only --permissions dlrw --expiry $end -o tsv`RHCOS VHD をストレージコンテナーにコピーします。

$ az storage blob copy start --account-name ${STORAGE_ACCOUNT_NAME} --sas-token "$sas" \ --source-uri "${RHCOS_VHD_ORIGIN_URL}" \ --destination-blob "${BLOB_NAME}" --destination-container ${CONTAINER_NAME}次のコマンドを使用して、コピープロセスのステータスを確認できます。

$ az storage blob show -c ${CONTAINER_NAME} -n ${BLOB_NAME} --account-name ${STORAGE_ACCOUNT_NAME} | jq .properties.copy出力例

{ "completionTime": null, "destinationSnapshot": null, "id": "1fd97630-03ca-489a-8c4e-cfe839c9627d", "incrementalCopy": null, "progress": "17179869696/17179869696", "source": "https://rhcos.blob.core.windows.net/imagebucket/rhcos-411.86.202207130959-0-azure.aarch64.vhd", "status": "success",1 "statusDescription": null }- 1

- status パラメーターに

successオブジェクトが表示されたら、コピープロセスは完了です。

次のコマンドを使用してイメージギャラリーを作成します。

$ az sig create --resource-group ${RESOURCE_GROUP} --gallery-name ${GALLERY_NAME}イメージギャラリーを使用してイメージ定義を作成します。次のコマンド例では、

rhcos-arm64がイメージ定義の名前です。$ az sig image-definition create --resource-group ${RESOURCE_GROUP} --gallery-name ${GALLERY_NAME} --gallery-image-definition rhcos-arm64 --publisher RedHat --offer arm --sku arm64 --os-type linux --architecture Arm64 --hyper-v-generation V2VHD の URL を取得してファイル名として

RHCOS_VHD_URLに設定するには、次のコマンドを実行します。$ RHCOS_VHD_URL=$(az storage blob url --account-name ${STORAGE_ACCOUNT_NAME} -c ${CONTAINER_NAME} -n "${BLOB_NAME}" -o tsv)RHCOS_VHD_URLファイル、ストレージアカウント、リソースグループ、およびイメージギャラリーを使用して、イメージバージョンを作成します。次の例では、1.0.0がイメージバージョンです。$ az sig image-version create --resource-group ${RESOURCE_GROUP} --gallery-name ${GALLERY_NAME} --gallery-image-definition rhcos-arm64 --gallery-image-version 1.0.0 --os-vhd-storage-account ${STORAGE_ACCOUNT_NAME} --os-vhd-uri ${RHCOS_VHD_URL}arm64ブートイメージが生成されました。次のコマンドを使用して、イメージの ID にアクセスできます。$ az sig image-version show -r $GALLERY_NAME -g $RESOURCE_GROUP -i rhcos-arm64 -e 1.0.0次の例のイメージ ID は、コンピュートマシンセットの

recourseIDパラメーターで使用されます。resourceIDの例/resourceGroups/${RESOURCE_GROUP}/providers/Microsoft.Compute/galleries/${GALLERY_NAME}/images/rhcos-arm64/versions/1.0.0

4.2.3. マルチアーキテクチャーコンピューティングマシンセットをクラスターに追加する

ARM64 コンピュートノードをクラスターに追加するには、ARM64 ブートイメージを使用する Azure コンピューティングマシンセットを作成する必要があります。Azure で独自のカスタムコンピュートマシンセットを作成するには、"Azure でのコンピュートマシンセットの作成" を参照してください。

前提条件

-

OpenShift CLI (

oc) がインストールされている。

手順

以下のコマンドで、コンピュートマシンセットを作成し、

resourceIDおよびvmSizeパラメーターを変更します。このコンピュートマシンセットは、クラスター内のarm64ワーカーノードを制御します。$ oc create -f arm64-machine-set-0.yamlarm64ブートイメージを使用したサンプル YAML コンピュートマシンセットapiVersion: machine.openshift.io/v1beta1 kind: MachineSet metadata: labels: machine.openshift.io/cluster-api-cluster: <infrastructure_id> machine.openshift.io/cluster-api-machine-role: worker machine.openshift.io/cluster-api-machine-type: worker name: <infrastructure_id>-arm64-machine-set-0 namespace: openshift-machine-api spec: replicas: 2 selector: matchLabels: machine.openshift.io/cluster-api-cluster: <infrastructure_id> machine.openshift.io/cluster-api-machineset: <infrastructure_id>-arm64-machine-set-0 template: metadata: labels: machine.openshift.io/cluster-api-cluster: <infrastructure_id> machine.openshift.io/cluster-api-machine-role: worker machine.openshift.io/cluster-api-machine-type: worker machine.openshift.io/cluster-api-machineset: <infrastructure_id>-arm64-machine-set-0 spec: lifecycleHooks: {} metadata: {} providerSpec: value: acceleratedNetworking: true apiVersion: machine.openshift.io/v1beta1 credentialsSecret: name: azure-cloud-credentials namespace: openshift-machine-api image: offer: "" publisher: "" resourceID: /resourceGroups/${RESOURCE_GROUP}/providers/Microsoft.Compute/galleries/${GALLERY_NAME}/images/rhcos-arm64/versions/1.0.01 sku: "" version: "" kind: AzureMachineProviderSpec location: <region> managedIdentity: <infrastructure_id>-identity networkResourceGroup: <infrastructure_id>-rg osDisk: diskSettings: {} diskSizeGB: 128 managedDisk: storageAccountType: Premium_LRS osType: Linux publicIP: false publicLoadBalancer: <infrastructure_id> resourceGroup: <infrastructure_id>-rg subnet: <infrastructure_id>-worker-subnet userDataSecret: name: worker-user-data vmSize: Standard_D4ps_v52 vnet: <infrastructure_id>-vnet zone: "<zone>"

検証

次のコマンドを入力して、新しい ARM64 マシンが実行されていることを確認します。

$ oc get machineset -n openshift-machine-api出力例

NAME DESIRED CURRENT READY AVAILABLE AGE <infrastructure_id>-arm64-machine-set-0 2 2 2 2 10m次のコマンドを使用すると、ノードの準備ができており、スケジュール可能であることを確認できます。

$ oc get nodes

4.3. AWS 上でマルチアーキテクチャーのコンピューティングマシンを含むクラスターを作成する

マルチアーキテクチャーのコンピューティングマシンを含む AWS クラスターを作成するには、まずマルチアーキテクチャーインストーラーバイナリーを使用して、単一アーキテクチャーの AWS インストーラーによってプロビジョニングされたクラスターを作成する必要があります。AWS のインストールの詳細は、カスタマイズを使用した AWS へのクラスターのインストール を参照してください。その後、ARM64 コンピューティングマシンセットを AWS クラスターに追加できます。

4.3.1. クラスターの互換性の確認

異なるアーキテクチャーのコンピュートノードをクラスターに追加する前に、クラスターがマルチアーキテクチャー互換であることを確認する必要があります。

前提条件

-

OpenShift CLI (

oc) がインストールされている。

手順

次のコマンドを実行すると、クラスターがアーキテクチャーペイロードを使用していることを確認できます。

$ oc adm release info -o jsonpath="{ .metadata.metadata}"

検証

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用しています。

{ "release.openshift.io/architecture": "multi", "url": "https://access.redhat.com/errata/<errata_version>" }その後、クラスターへのマルチアーキテクチャーコンピュートノードの追加を開始できます。

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用していません。

{ "url": "https://access.redhat.com/errata/<errata_version>" }重要クラスターを、マルチアーキテクチャーコンピュートマシンをサポートするクラスターに移行するには、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 の手順に従ってください。

4.3.2. ARM64 コンピューティングマシンセットをクラスターに追加する

マルチアーキテクチャーのコンピューティングマシンでクラスターを設定するには、AWS ARM64 コンピューティングマシンセットを作成する必要があります。これにより、クラスターに ARM64 コンピュートノードが追加され、クラスターにマルチアーキテクチャーのコンピューティングマシンが含まれるようになります。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 - インストールプログラムを使用して、マルチアーキテクチャーインストーラーバイナリーを含む AMD64 単一アーキテクチャー AWS クラスターを作成しました。

手順

計算マシンセットを作成および変更します。これにより、クラスター内の ARM64 コンピュートノードが制御されます。

$ oc create -f aws-arm64-machine-set-0.yamlARM64 コンピュートノードをデプロイするためのサンプル YAML コンピューティングマシンセット

apiVersion: machine.openshift.io/v1beta1 kind: MachineSet metadata: labels: machine.openshift.io/cluster-api-cluster: <infrastructure_id>1 name: <infrastructure_id>-aws-arm64-machine-set-02 namespace: openshift-machine-api spec: replicas: 1 selector: matchLabels: machine.openshift.io/cluster-api-cluster: <infrastructure_id>3 machine.openshift.io/cluster-api-machineset: <infrastructure_id>-<role>-<zone>4 template: metadata: labels: machine.openshift.io/cluster-api-cluster: <infrastructure_id> machine.openshift.io/cluster-api-machine-role: <role>5 machine.openshift.io/cluster-api-machine-type: <role>6 machine.openshift.io/cluster-api-machineset: <infrastructure_id>-<role>-<zone>7 spec: metadata: labels: node-role.kubernetes.io/<role>: "" providerSpec: value: ami: id: ami-02a574449d4f4d2808 apiVersion: awsproviderconfig.openshift.io/v1beta1 blockDevices: - ebs: iops: 0 volumeSize: 120 volumeType: gp2 credentialsSecret: name: aws-cloud-credentials deviceIndex: 0 iamInstanceProfile: id: <infrastructure_id>-worker-profile9 instanceType: m6g.xlarge10 kind: AWSMachineProviderConfig placement: availabilityZone: us-east-1a11 region: <region>12 securityGroups: - filters: - name: tag:Name values: - <infrastructure_id>-worker-sg13 subnet: filters: - name: tag:Name values: - <infrastructure_id>-private-<zone> tags: - name: kubernetes.io/cluster/<infrastructure_id>14 value: owned - name: <custom_tag_name> value: <custom_tag_value> userDataSecret: name: worker-user-data- 1 2 3 9 13 14

- クラスターのプロビジョニング時に設定したクラスター ID を基にするインフラストラクチャー ID を指定します。OpenShift CLI がインストールされている場合は、以下のコマンドを実行してインフラストラクチャー ID を取得できます。

$ oc get -o jsonpath=‘{.status.infrastructureName}{“\n”}’ infrastructure cluster - 4 7

- インフラストラクチャー ID、ロールノードラベル、およびゾーンを指定します。

- 5 6

- 追加するロールノードラベルを指定します。

- 8

- OpenShift Container Platform ノードの AWS ゾーンに、ARM64 がサポートする Red Hat Enterprise Linux CoreOS (RHCOS) Amazon Machine Image (AMI) を指定します。

$ oc get configmap/coreos-bootimages \ -n openshift-machine-config-operator \ -o jsonpath='{.data.stream}' | jq \ -r '.architectures.<arch>.images.aws.regions."<region>".image' - 10

- ARM64 がサポートするマシンタイプを指定します。詳細については、"AWS 64 ビット ARM のテスト済みインスタンスタイプ" を参照してください。

- 11

- ゾーンを指定します (例:

us-east-1a)。選択したゾーンが 64 ビット ARM マシンを提供していることを確認してください。 - 12

- リージョン (例:

us-east-1) を指定します。選択したゾーンが 64 ビット ARM マシンを提供していることを確認してください。

検証

次のコマンドを入力して、コンピューティングマシンセットのリストを表示します。

$ oc get machineset -n openshift-machine-api作成した ARM64 マシンセットを確認できます。

出力例

NAME DESIRED CURRENT READY AVAILABLE AGE <infrastructure_id>-aws-arm64-machine-set-0 2 2 2 2 10m次のコマンドを使用すると、ノードの準備ができており、スケジュール可能であることを確認できます。

$ oc get nodes

4.4. Google Cloud でマルチアーキテクチャーのコンピューティングマシンを含むクラスターを作成する

マルチアーキテクチャーのコンピューティングマシンを含む Google Cloud クラスターを作成するには、まずマルチアーキテクチャーインストーラーバイナリーを使用して、単一アーキテクチャーの Google Cloud インストーラーによってプロビジョニングされたクラスターを作成する必要があります。AWS のインストールの詳細については、カスタマイズを使用した Google Cloud へのクラスターのインストール を参照してください。その後、ARM64 コンピューティングマシンセットを Google Cloud クラスターに追加できます。

現在、Google Cloud の ARM64 マシンではセキュアブートはサポートされていません

4.4.1. クラスターの互換性の確認

異なるアーキテクチャーのコンピュートノードをクラスターに追加する前に、クラスターがマルチアーキテクチャー互換であることを確認する必要があります。

前提条件

-

OpenShift CLI (

oc) がインストールされている。

手順

次のコマンドを実行すると、クラスターがアーキテクチャーペイロードを使用していることを確認できます。

$ oc adm release info -o jsonpath="{ .metadata.metadata}"

検証

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用しています。

{ "release.openshift.io/architecture": "multi", "url": "https://access.redhat.com/errata/<errata_version>" }その後、クラスターへのマルチアーキテクチャーコンピュートノードの追加を開始できます。

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用していません。

{ "url": "https://access.redhat.com/errata/<errata_version>" }重要クラスターを、マルチアーキテクチャーコンピュートマシンをサポートするクラスターに移行するには、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 の手順に従ってください。

4.4.2. ARM64 コンピューティングマシンセットを Google Cloud クラスターに追加する

マルチアーキテクチャーのコンピューティングマシンでクラスターを設定するには、Google Cloud ARM64 コンピューティングマシンセットを作成する必要があります。これにより、ARM64 コンピュートノードがクラスターに追加されます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 - インストールプログラムを使用して、マルチアーキテクチャーインストーラーバイナリーを含む AMD64 単一アーキテクチャー AWS クラスターを作成しました。

手順

計算マシンセットを作成および変更します。これにより、クラスター内の ARM64 コンピュートノードが制御されます。

$ oc create -f gcp-arm64-machine-set-0.yamlARM64 コンピュートノードをデプロイするためのサンプル Google Cloud YAML コンピューティングマシンセット

apiVersion: machine.openshift.io/v1beta1 kind: MachineSet metadata: labels: machine.openshift.io/cluster-api-cluster: <infrastructure_id>1 name: <infrastructure_id>-w-a namespace: openshift-machine-api spec: replicas: 1 selector: matchLabels: machine.openshift.io/cluster-api-cluster: <infrastructure_id> machine.openshift.io/cluster-api-machineset: <infrastructure_id>-w-a template: metadata: creationTimestamp: null labels: machine.openshift.io/cluster-api-cluster: <infrastructure_id> machine.openshift.io/cluster-api-machine-role: <role>2 machine.openshift.io/cluster-api-machine-type: <role> machine.openshift.io/cluster-api-machineset: <infrastructure_id>-w-a spec: metadata: labels: node-role.kubernetes.io/<role>: "" providerSpec: value: apiVersion: gcpprovider.openshift.io/v1beta1 canIPForward: false credentialsSecret: name: gcp-cloud-credentials deletionProtection: false disks: - autoDelete: true boot: true image: <path_to_image>3 labels: null sizeGb: 128 type: pd-ssd gcpMetadata:4 - key: <custom_metadata_key> value: <custom_metadata_value> kind: GCPMachineProviderSpec machineType: n1-standard-45 metadata: creationTimestamp: null networkInterfaces: - network: <infrastructure_id>-network subnetwork: <infrastructure_id>-worker-subnet projectID: <project_name>6 region: us-central17 serviceAccounts: - email: <infrastructure_id>-w@<project_name>.iam.gserviceaccount.com scopes: - https://www.googleapis.com/auth/cloud-platform tags: - <infrastructure_id>-worker userDataSecret: name: worker-user-data zone: us-central1-a- 1

- クラスターのプロビジョニング時に設定したクラスター ID を基にするインフラストラクチャー ID を指定します。以下のコマンドを実行してインフラストラクチャー ID を取得できます。

$ oc get -o jsonpath='{.status.infrastructureName}{"\n"}' infrastructure cluster - 2

- 追加するロールノードラベルを指定します。

- 3

- 現在のコンピュートマシンセットで使用されるイメージへのパスを指定します。イメージへのパスにはプロジェクトとイメージ名が必要です。

プロジェクトとイメージ名にアクセスするには、次のコマンドを実行します。

$ oc get configmap/coreos-bootimages \ -n openshift-machine-config-operator \ -o jsonpath='{.data.stream}' | jq \ -r '.architectures.aarch64.images.gcp'出力例

"gcp": { "release": "415.92.202309142014-0", "project": "rhcos-cloud", "name": "rhcos-415-92-202309142014-0-gcp-aarch64" }出力の

projectパラメーターとnameパラメーターを使用して、マシンセット内のイメージフィールドへのパスを作成します。イメージへのパスは次の形式に従う必要があります。$ projects/<project>/global/images/<image_name> - 4

- オプション:

key:valueのペアの形式でカスタムメタデータを指定します。ユースケースの例については、カスタムメタデータの設定 について Google Cloud のドキュメント を参照してください。 - 5

- ARM64 がサポートするマシンタイプを指定します。詳細については、関連情報の 64 ビット ARM インフラストラクチャー上の Google Cloud のテスト済みインスタンスタイプ を参照してください。

- 6

- クラスターに使用する Google Cloud プロジェクトの名前を指定します。

- 7

- リージョンを指定します (例:

us-central1)。選択したゾーンが 64 ビット ARM マシンを提供していることを確認してください。

検証

次のコマンドを入力して、コンピューティングマシンセットのリストを表示します。

$ oc get machineset -n openshift-machine-api作成した ARM64 マシンセットを確認できます。

出力例

NAME DESIRED CURRENT READY AVAILABLE AGE <infrastructure_id>-gcp-arm64-machine-set-0 2 2 2 2 10m次のコマンドを使用すると、ノードの準備ができており、スケジュール可能であることを確認できます。

$ oc get nodes

4.5. ベアメタル上でマルチアーキテクチャーのコンピューティングマシンを含むクラスターを作成する

ベアメタル上にマルチアーキテクチャーのコンピューティングマシンを含むクラスターを作成するには、既存の単一アーキテクチャーのベアメタルクラスターが必要です。ベアメタルのインストールの詳細は、ユーザーがプロビジョニングしたクラスターをベアメタルにインストールする を参照してください。その後、ベアメタル上の OpenShift Container Platform クラスターに 64 ビット ARM コンピューティングマシンを追加できます。

64 ビット ARM ノードをベアメタルクラスターに追加する前に、クラスターをマルチアーキテクチャーペイロードを使用するクラスターにアップグレードする必要があります。マルチアーキテクチャーペイロードへの移行の詳細は、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 を参照してください。

次の手順では、ISO イメージまたはネットワーク PXE ブートを使用して RHCOS コンピューティングマシンを作成する方法について説明します。これにより、ARM64 ノードをベアメタルクラスターに追加し、マルチアーキテクチャーのコンピューティングマシンを含むクラスターをデプロイメントできるようになります。

4.5.1. クラスターの互換性の確認

異なるアーキテクチャーのコンピュートノードをクラスターに追加する前に、クラスターがマルチアーキテクチャー互換であることを確認する必要があります。

前提条件

-

OpenShift CLI (

oc) がインストールされている。

手順

次のコマンドを実行すると、クラスターがアーキテクチャーペイロードを使用していることを確認できます。

$ oc adm release info -o jsonpath="{ .metadata.metadata}"

検証

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用しています。

{ "release.openshift.io/architecture": "multi", "url": "https://access.redhat.com/errata/<errata_version>" }その後、クラスターへのマルチアーキテクチャーコンピュートノードの追加を開始できます。

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用していません。

{ "url": "https://access.redhat.com/errata/<errata_version>" }重要クラスターを、マルチアーキテクチャーコンピュートマシンをサポートするクラスターに移行するには、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 の手順に従ってください。

4.5.2. ISO イメージを使用した RHCOS マシンの作成

ISO イメージを使用して、ベアメタルクラスターの追加の Red Hat Enterprise Linux CoreOS (RHCOS) コンピュートマシンを作成できます。

前提条件

- クラスターのコンピュートマシンの Ignition 設定ファイルの URL を取得します。このファイルがインストール時に HTTP サーバーにアップロードされている必要があります。

-

OpenShift CLI (

oc) がインストールされている。

手順

次のコマンドを実行して、クラスターから Ignition 設定ファイルを抽出します。

$ oc extract -n openshift-machine-api secret/worker-user-data-managed --keys=userData --to=- > worker.ign-

クラスターからエクスポートした

worker.ignIgnition 設定ファイルを HTTP サーバーにアップロードします。これらのファイルの URL をメモします。 Ignition ファイルが URL で利用可能であることを検証できます。次の例では、コンピュートノードの Ignition 設定ファイルを取得します。

$ curl -k http://<HTTP_server>/worker.ign次のコマンドを実行すると、新しいマシンを起動するための ISO イメージにアクセスできます。

RHCOS_VHD_ORIGIN_URL=$(oc -n openshift-machine-config-operator get configmap/coreos-bootimages -o jsonpath='{.data.stream}' | jq -r '.architectures.<architecture>.artifacts.metal.formats.iso.disk.location')ISO ファイルを使用して、追加のコンピュートマシンに RHCOS をインストールします。クラスターのインストール前にマシンを作成する際に使用したのと同じ方法を使用します。

- ディスクに ISO イメージを書き込み、これを直接起動します。

- LOM インターフェイスで ISO リダイレクトを使用します。

オプションを指定したり、ライブ起動シーケンスを中断したりせずに、RHCOS ISO イメージを起動します。インストーラーが RHCOS ライブ環境でシェルプロンプトを起動するのを待ちます。

注記RHCOS インストールの起動プロセスを中断して、カーネル引数を追加できます。ただし、この ISO 手順では、カーネル引数を追加する代わりに、次の手順で概説するように

coreos-installerコマンドを使用する必要があります。coreos-installerコマンドを実行し、インストール要件を満たすオプションを指定します。少なくとも、ノードタイプの Ignition 設定ファイルを参照する URL と、インストール先のデバイスを指定する必要があります。$ sudo coreos-installer install --ignition-url=http://<HTTP_server>/<node_type>.ign <device> --ignition-hash=sha512-<digest>1 2 注記TLS を使用する HTTPS サーバーを使用して Ignition 設定ファイルを提供する場合は、

coreos-installerを実行する前に、内部認証局 (CA) をシステムのトラストストアに追加できます。以下の例では、

/dev/sdaデバイスへのコンピュートノードのインストールを初期化します。コンピュートノードの Ignition 設定ファイルは、IP アドレス 192.168.1.2 で HTTP Web サーバーから取得されます。$ sudo coreos-installer install --ignition-url=http://192.168.1.2:80/installation_directory/worker.ign /dev/sda --ignition-hash=sha512-a5a2d43879223273c9b60af66b44202a1d1248fc01cf156c46d4a79f552b6bad47bc8cc78ddf0116e80c59d2ea9e32ba53bc807afbca581aa059311def2c3e3bマシンのコンソールで RHCOS インストールの進捗を監視します。

重要OpenShift Container Platform のインストールを開始する前に、各ノードでインストールが成功していることを確認します。インストールプロセスを監視すると、発生する可能性のある RHCOS インストールの問題の原因を特定する上でも役立ちます。

- 継続してクラスター用の追加のコンピュートマシンを作成します。

4.5.3. PXE または iPXE ブートによる RHCOS マシンの作成

PXE または iPXE ブートを使用して、ベアメタルクラスターの追加の Red Hat Enterprise Linux CoreOS (RHCOS) コンピュートマシンを作成できます。

前提条件

- クラスターのコンピュートマシンの Ignition 設定ファイルの URL を取得します。このファイルがインストール時に HTTP サーバーにアップロードされている必要があります。

-

クラスターのインストール時に HTTP サーバーにアップロードした RHCOS ISO イメージ、圧縮されたメタル BIOS、

kernel、およびinitramfsファイルの URL を取得します。 - インストール時に OpenShift Container Platform クラスターのマシンを作成するために使用した PXE ブートインフラストラクチャーにアクセスできる必要があります。RHCOS のインストール後にマシンはローカルディスクから起動する必要があります。

-

UEFI を使用する場合、OpenShift Container Platform のインストール時に変更した

grub.confファイルにアクセスできます。

手順

RHCOS イメージの PXE または iPXE インストールが正常に行われていることを確認します。

PXE の場合:

DEFAULT pxeboot TIMEOUT 20 PROMPT 0 LABEL pxeboot KERNEL http://<HTTP_server>/rhcos-<version>-live-kernel-<architecture>1 APPEND initrd=http://<HTTP_server>/rhcos-<version>-live-initramfs.<architecture>.img coreos.inst.install_dev=/dev/sda coreos.inst.ignition_url=http://<HTTP_server>/worker.ign coreos.live.rootfs_url=http://<HTTP_server>/rhcos-<version>-live-rootfs.<architecture>.img2 - 1

- HTTP サーバーにアップロードしたライブ

kernelファイルの場所を指定します。 - 2

- HTTP サーバーにアップロードした RHCOS ファイルの場所を指定します。

initrdパラメーターはライブinitramfsファイルの場所であり、coreos.inst.ignition_urlパラメーター値はワーカー Ignition 設定ファイルの場所であり、coreos.live.rootfs_urlパラメーター値はライブrootfsファイルの場所になります。coreos.inst.ignition_urlおよびcoreos.live.rootfs_urlパラメーターは HTTP および HTTPS のみをサポートします。

注記この設定では、グラフィカルコンソールを使用するマシンでシリアルコンソールアクセスを有効にしません。別のコンソールを設定するには、

APPEND行に 1 つ以上のconsole=引数を追加します。たとえば、console=tty0 console=ttyS0を追加して、最初の PC シリアルポートをプライマリーコンソールとして、グラフィカルコンソールをセカンダリーコンソールとして設定します。詳細は、How does one set up a serial terminal and/or console in Red Hat Enterprise Linux? を参照してください。iPXE (

x86_64+aarch64) の場合:kernel http://<HTTP_server>/rhcos-<version>-live-kernel-<architecture> initrd=main coreos.live.rootfs_url=http://<HTTP_server>/rhcos-<version>-live-rootfs.<architecture>.img coreos.inst.install_dev=/dev/sda coreos.inst.ignition_url=http://<HTTP_server>/worker.ign1 2 initrd --name main http://<HTTP_server>/rhcos-<version>-live-initramfs.<architecture>.img3 boot- 1

- HTTP サーバーにアップロードした RHCOS ファイルの場所を指定します。

kernelパラメーター値はkernelファイルの場所であり、initrd=main引数は UEFI システムでの起動に必要であり、coreos.live.rootfs_urlパラメーター値はワーカー Ignition 設定ファイルの場所であり、coreos.inst.ignition_urlパラメーター値はrootfsのライブファイルの場所です。 - 2

- 複数の NIC を使用する場合、

ipオプションに単一インターフェイスを指定します。たとえば、eno1という名前の NIC で DHCP を使用するには、ip=eno1:dhcpを設定します。 - 3

- HTTP サーバーにアップロードした

initramfsファイルの場所を指定します。

注記この設定では、グラフィカルコンソールを備えたマシンでのシリアルコンソールアクセスは有効になりません。別のコンソールを設定するには、

kernel行に 1 つ以上のconsole=引数を追加します。たとえば、console=tty0 console=ttyS0を追加して、最初の PC シリアルポートをプライマリーコンソールとして、グラフィカルコンソールをセカンダリーコンソールとして設定します。詳細は、How does one set up a serial terminal and/or console in Red Hat Enterprise Linux? と、「高度な RHCOS インストール設定」セクションの「PXE および ISO インストール用シリアルコンソールの有効化」を参照してください。注記aarch64アーキテクチャーで CoreOSkernelをネットワークブートするには、IMAGE_GZIPオプションが有効になっているバージョンの iPXE ビルドを使用する必要があります。iPXE のIMAGE_GZIPオプション を参照してください。aarch64上の PXE (第 2 段階として UEFI および GRUB を使用) の場合:menuentry 'Install CoreOS' { linux rhcos-<version>-live-kernel-<architecture> coreos.live.rootfs_url=http://<HTTP_server>/rhcos-<version>-live-rootfs.<architecture>.img coreos.inst.install_dev=/dev/sda coreos.inst.ignition_url=http://<HTTP_server>/worker.ign1 2 initrd rhcos-<version>-live-initramfs.<architecture>.img3 }- 1

- HTTP/TFTP サーバーにアップロードした RHCOS ファイルの場所を指定します。

kernelパラメーター値は、TFTP サーバー上のkernelファイルの場所になります。coreos.live.rootfs_urlパラメーター値はrootfsファイルの場所であり、coreos.inst.ignition_urlパラメーター値は HTTP サーバー上のブートストラップ Ignition 設定ファイルの場所になります。 - 2

- 複数の NIC を使用する場合、

ipオプションに単一インターフェイスを指定します。たとえば、eno1という名前の NIC で DHCP を使用するには、ip=eno1:dhcpを設定します。 - 3

- TFTP サーバーにアップロードした

initramfsファイルの場所を指定します。

- PXE または iPXE インフラストラクチャーを使用して、クラスターに必要なコンピュートマシンを作成します。

4.5.4. マシンの証明書署名要求の承認

マシンをクラスターに追加する際に、追加したそれぞれのマシンに対して 2 つの保留状態の証明書署名要求 (CSR) が生成されます。これらの CSR が承認されていることを確認するか、必要な場合はそれらを承認してください。最初にクライアント要求を承認し、次にサーバー要求を承認する必要があります。

前提条件

- マシンがクラスターに追加されています。

手順

クラスターがマシンを認識していることを確認します。

$ oc get nodes出力例

NAME STATUS ROLES AGE VERSION master-0 Ready master 63m v1.27.3 master-1 Ready master 63m v1.27.3 master-2 Ready master 64m v1.27.3出力には作成したすべてのマシンがリスト表示されます。

注記上記の出力には、一部の CSR が承認されるまで、ワーカーノード (ワーカーノードとも呼ばれる) が含まれない場合があります。

保留中の証明書署名要求 (CSR) を確認し、クラスターに追加したそれぞれのマシンのクライアントおよびサーバー要求に

PendingまたはApprovedステータスが表示されていることを確認します。$ oc get csr出力例

NAME AGE REQUESTOR CONDITION csr-8b2br 15m system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending csr-8vnps 15m system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending ...この例では、2 つのマシンがクラスターに参加しています。このリストにはさらに多くの承認された CSR が表示される可能性があります。

追加したマシンの保留中の CSR すべてが

Pendingステータスになった後に CSR が承認されない場合には、クラスターマシンの CSR を承認します。注記CSR のローテーションは自動的に実行されるため、クラスターにマシンを追加後 1 時間以内に CSR を承認してください。1 時間以内に承認しない場合には、証明書のローテーションが行われ、各ノードに 3 つ以上の証明書が存在するようになります。これらの証明書すべてを承認する必要があります。クライアントの CSR が承認された後に、Kubelet は提供証明書のセカンダリー CSR を作成します。これには、手動の承認が必要になります。次に、後続の提供証明書の更新要求は、Kubelet が同じパラメーターを持つ新規証明書を要求する場合に

machine-approverによって自動的に承認されます。注記ベアメタルおよび他の user-provisioned infrastructure などのマシン API ではないプラットフォームで実行されているクラスターの場合、kubelet 提供証明書要求 (CSR) を自動的に承認する方法を実装する必要があります。要求が承認されない場合、API サーバーが kubelet に接続する際に提供証明書が必須であるため、

oc exec、oc rsh、およびoc logsコマンドは正常に実行できません。Kubelet エンドポイントにアクセスする操作には、この証明書の承認が必要です。この方法は新規 CSR の有無を監視し、CSR がsystem:nodeまたはsystem:adminグループのnode-bootstrapperサービスアカウントによって提出されていることを確認し、ノードの ID を確認します。それらを個別に承認するには、それぞれの有効な CSR に以下のコマンドを実行します。

$ oc adm certificate approve <csr_name>1 - 1

<csr_name>は、現行の CSR のリストからの CSR の名前です。

すべての保留中の CSR を承認するには、以下のコマンドを実行します。

$ oc get csr -o go-template='{{range .items}}{{if not .status}}{{.metadata.name}}{{"\n"}}{{end}}{{end}}' | xargs --no-run-if-empty oc adm certificate approve注記一部の Operator は、一部の CSR が承認されるまで利用できない可能性があります。

クライアント要求が承認されたら、クラスターに追加した各マシンのサーバー要求を確認する必要があります。

$ oc get csr出力例

NAME AGE REQUESTOR CONDITION csr-bfd72 5m26s system:node:ip-10-0-50-126.us-east-2.compute.internal Pending csr-c57lv 5m26s system:node:ip-10-0-95-157.us-east-2.compute.internal Pending ...残りの CSR が承認されず、それらが

Pendingステータスにある場合、クラスターマシンの CSR を承認します。それらを個別に承認するには、それぞれの有効な CSR に以下のコマンドを実行します。

$ oc adm certificate approve <csr_name>1 - 1

<csr_name>は、現行の CSR のリストからの CSR の名前です。

すべての保留中の CSR を承認するには、以下のコマンドを実行します。

$ oc get csr -o go-template='{{range .items}}{{if not .status}}{{.metadata.name}}{{"\n"}}{{end}}{{end}}' | xargs oc adm certificate approve

すべてのクライアントおよびサーバーの CSR が承認された後に、マシンのステータスが

Readyになります。以下のコマンドを実行して、これを確認します。$ oc get nodes出力例

NAME STATUS ROLES AGE VERSION master-0 Ready master 73m v1.27.3 master-1 Ready master 73m v1.27.3 master-2 Ready master 74m v1.27.3 worker-0 Ready worker 11m v1.27.3 worker-1 Ready worker 11m v1.27.3注記サーバー CSR の承認後にマシンが

Readyステータスに移行するまでに数分の時間がかかる場合があります。

関連情報

- CSR の詳細は、Certificate Signing Requests を参照してください。

4.6. z/VM を使用した IBM Z および IBM LinuxONE 上でマルチアーキテクチャーのコンピューティングマシンを含むクラスターを作成する

z/VM を使用して IBM Z® および IBM® LinuxONE (s390x) 上にマルチアーキテクチャーのコンピュートマシンを含むクラスターを作成するには、既存の単一アーキテクチャーの x86_64 クラスターが必要です。その後、s390x コンピュートマシンを OpenShift Container Platform クラスターに追加できます。

s390x ノードをクラスターに追加する前に、クラスターをマルチアーキテクチャーペイロードを使用するクラスターにアップグレードする必要があります。マルチアーキテクチャーペイロードへの移行の詳細は、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 を参照してください。

次の手順では、z/VM インスタンスを使用して RHCOS コンピュートマシンを作成する方法を説明します。これにより、s390x ノードをクラスターに追加し、マルチアーキテクチャーのコンピュートマシンを含むクラスターをデプロイメントできるようになります。

4.6.1. クラスターの互換性の確認

異なるアーキテクチャーのコンピュートノードをクラスターに追加する前に、クラスターがマルチアーキテクチャー互換であることを確認する必要があります。

前提条件

-

OpenShift CLI (

oc) がインストールされている。

手順

次のコマンドを実行すると、クラスターがアーキテクチャーペイロードを使用していることを確認できます。

$ oc adm release info -o jsonpath="{ .metadata.metadata}"

検証

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用しています。

{ "release.openshift.io/architecture": "multi", "url": "https://access.redhat.com/errata/<errata_version>" }その後、クラスターへのマルチアーキテクチャーコンピュートノードの追加を開始できます。

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用していません。

{ "url": "https://access.redhat.com/errata/<errata_version>" }重要クラスターを、マルチアーキテクチャーコンピュートマシンをサポートするクラスターに移行するには、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 の手順に従ってください。

4.6.2. z/VM を使用した IBM Z 上での RHCOS マシンの作成

z/VM を使用した IBM Z® 上で実行される Red Hat Enterprise Linux CoreOS (RHCOS) コンピュートマシンをさらに作成し、既存のクラスターに割り当てることができます。

前提条件

- ノードのホスト名および逆引き参照を実行できるドメインネームサーバー (DNS) がある。

- 作成するマシンがアクセスできるプロビジョニングマシンで稼働している HTTP または HTTPS サーバーがある。

手順

UDP アグリゲーションを無効にします。

現在、UDP アグリゲーションは IBM Z® ではサポートされておらず、

x86_64コントロールプレーンと追加のs390xコンピュートマシンを備えたマルチアーキテクチャーコンピュートクラスターでは自動的に非アクティブ化されません。追加のコンピュートノードがクラスターに正しく追加されるようにするには、UDP アグリゲーションを手動で無効にする必要があります。次の内容を含む YAML ファイル

udp-aggregation-config.yamlを作成します。apiVersion: v1 kind: ConfigMap data: disable-udp-aggregation: "true" metadata: name: udp-aggregation-config namespace: openshift-network-operator次のコマンドを実行して、ConfigMap リソースを作成します。

$ oc create -f udp-aggregation-config.yaml

次のコマンドを実行して、クラスターから Ignition 設定ファイルを抽出します。

$ oc extract -n openshift-machine-api secret/worker-user-data-managed --keys=userData --to=- > worker.ign-

クラスターからエクスポートした

worker.ignIgnition 設定ファイルを HTTP サーバーにアップロードします。このファイルの URL をメモします。 Ignition ファイルが URL で利用可能であることを検証できます。次の例では、コンピュートノードの Ignition 設定ファイルを取得します。

$ curl -k http://<HTTP_server>/worker.ign次のコマンドを実行して、RHEL ライブ

kernel、initramfs、およびrootfsファイルをダウンロードします。$ curl -LO $(oc -n openshift-machine-config-operator get configmap/coreos-bootimages -o jsonpath='{.data.stream}' \ | jq -r '.architectures.s390x.artifacts.metal.formats.pxe.kernel.location')$ curl -LO $(oc -n openshift-machine-config-operator get configmap/coreos-bootimages -o jsonpath='{.data.stream}' \ | jq -r '.architectures.s390x.artifacts.metal.formats.pxe.initramfs.location')$ curl -LO $(oc -n openshift-machine-config-operator get configmap/coreos-bootimages -o jsonpath='{.data.stream}' \ | jq -r '.architectures.s390x.artifacts.metal.formats.pxe.rootfs.location')-

ダウンロードした RHEL ライブ

kernel、initramfs、およびrootfsファイルを、追加する z/VM ゲストからアクセスできる HTTP または HTTPS サーバーに移動します。 z/VM ゲストのパラメーターファイルを作成します。次のパラメーターは仮想マシンに固有です。

オプション: 静的 IP アドレスを指定するには、次のエントリーをコロンで区切って

ip=パラメーターを追加します。- マシンの IP アドレス。

- 空の文字列。

- ゲートウェイ。

- ネットマスク。

-

hostname.domainname形式のマシンホストおよびドメイン名。この値を省略すると、RHCOS が逆引き DNS ルックアップによりホスト名を取得します。 - ネットワークインターフェイス名。この値を省略すると、RHCOS が利用可能なすべてのインターフェイスに IP 設定を適用します。

-

値

none。

-

coreos.inst.ignition_url=には、worker.ignファイルへの URL を指定します。HTTP プロトコルおよび HTTPS プロトコルのみがサポートされます。 -

coreos.live.rootfs_url=の場合、起動しているkernelおよびinitramfsの一致する rootfs アーティファクトを指定します。HTTP プロトコルおよび HTTPS プロトコルのみがサポートされます。 DASD タイプのディスクへのインストールには、以下のタスクを実行します。

-

coreos.inst.install_dev=には、/dev/dasdaを指定します。 -

rd.dasd=を使用して、RHCOS がインストールされる DASD を指定します。 その他のパラメーターはすべて変更しません。

以下はパラメーターファイルの例、

additional-worker-dasd.parmです。rd.neednet=1 \ console=ttysclp0 \ coreos.inst.install_dev=/dev/dasda \ coreos.live.rootfs_url=http://cl1.provide.example.com:8080/assets/rhcos-live-rootfs.s390x.img \ coreos.inst.ignition_url=http://cl1.provide.example.com:8080/ignition/worker.ign \ ip=172.18.78.2::172.18.78.1:255.255.255.0:::none nameserver=172.18.78.1 \ rd.znet=qeth,0.0.bdf0,0.0.bdf1,0.0.bdf2,layer2=1,portno=0 \ zfcp.allow_lun_scan=0 \ rd.dasd=0.0.3490パラメーターファイルのすべてのオプションを 1 行で記述し、改行文字がないことを確認します。

-

FCP タイプのディスクへのインストールには、以下のタスクを実行します。

rd.zfcp=<adapter>,<wwpn>,<lun>を使用して RHCOS がインストールされる FCP ディスクを指定します。マルチパスの場合、それぞれの追加のステップについてこのステップを繰り返します。注記複数のパスを使用してインストールする場合は、問題が発生する可能性があるため、後でではなくインストールの直後にマルチパスを有効にする必要があります。

インストールデバイスを

coreos.inst.install_dev=/dev/sdaとして設定します。注記追加の LUN が NPIV で設定される場合は、FCP に

zfcp.allow_lun_scan=0が必要です。CSI ドライバーを使用するためにzfcp.allow_lun_scan=1を有効にする必要がある場合などには、各ノードが別のノードのブートパーティションにアクセスできないように NPIV を設定する必要があります。その他のパラメーターはすべて変更しません。

重要マルチパスを完全に有効にするには、インストール後の追加の手順が必要です。詳細は、インストール後のマシン設定タスク の “RHCOS でのカーネル引数を使用したマルチパスの有効化“ を参照してください。

以下は、マルチパスを使用するワーカーノードのパラメーターファイルの例

additional-worker-fcp.parmです。rd.neednet=1 \ console=ttysclp0 \ coreos.inst.install_dev=/dev/sda \ coreos.live.rootfs_url=http://cl1.provide.example.com:8080/assets/rhcos-live-rootfs.s390x.img \ coreos.inst.ignition_url=http://cl1.provide.example.com:8080/ignition/worker.ign \ ip=172.18.78.2::172.18.78.1:255.255.255.0:::none nameserver=172.18.78.1 \ rd.znet=qeth,0.0.bdf0,0.0.bdf1,0.0.bdf2,layer2=1,portno=0 \ zfcp.allow_lun_scan=0 \ rd.zfcp=0.0.1987,0x50050763070bc5e3,0x4008400B00000000 \ rd.zfcp=0.0.19C7,0x50050763070bc5e3,0x4008400B00000000 \ rd.zfcp=0.0.1987,0x50050763071bc5e3,0x4008400B00000000 \ rd.zfcp=0.0.19C7,0x50050763071bc5e3,0x4008400B00000000パラメーターファイルのすべてのオプションを 1 行で記述し、改行文字がないことを確認します。

-

FTP などを使用し、

initramfs、kernel、パラメーターファイル、および RHCOS イメージを z/VM に転送します。FTP でファイルを転送し、仮想リーダーから起動する方法は、Z/VM 環境へのインストール を参照してください。 ファイルを z/VM ゲスト仮想マシンの仮想リーダーに punch します。

IBM® ドキュメントの PUNCH を参照してください。

ヒントCP PUNCH コマンドを使用するか、Linux を使用している場合は、vmur コマンドを使用して 2 つの z/VM ゲスト仮想マシン間でファイルを転送できます。

- ブートストラップマシンで CMS にログインします。

次のコマンドを実行して、リーダーからブートストラップマシンを IPL します。

$ ipl cIBM® ドキュメントの IPL を参照してください。

4.6.3. マシンの証明書署名要求の承認

マシンをクラスターに追加する際に、追加したそれぞれのマシンに対して 2 つの保留状態の証明書署名要求 (CSR) が生成されます。これらの CSR が承認されていることを確認するか、必要な場合はそれらを承認してください。最初にクライアント要求を承認し、次にサーバー要求を承認する必要があります。

前提条件

- マシンがクラスターに追加されています。

手順

クラスターがマシンを認識していることを確認します。

$ oc get nodes出力例

NAME STATUS ROLES AGE VERSION master-0 Ready master 63m v1.27.3 master-1 Ready master 63m v1.27.3 master-2 Ready master 64m v1.27.3出力には作成したすべてのマシンがリスト表示されます。

注記上記の出力には、一部の CSR が承認されるまで、ワーカーノード (ワーカーノードとも呼ばれる) が含まれない場合があります。

保留中の証明書署名要求 (CSR) を確認し、クラスターに追加したそれぞれのマシンのクライアントおよびサーバー要求に

PendingまたはApprovedステータスが表示されていることを確認します。$ oc get csr出力例

NAME AGE REQUESTOR CONDITION csr-8b2br 15m system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending csr-8vnps 15m system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending ...この例では、2 つのマシンがクラスターに参加しています。このリストにはさらに多くの承認された CSR が表示される可能性があります。

追加したマシンの保留中の CSR すべてが

Pendingステータスになった後に CSR が承認されない場合には、クラスターマシンの CSR を承認します。注記CSR のローテーションは自動的に実行されるため、クラスターにマシンを追加後 1 時間以内に CSR を承認してください。1 時間以内に承認しない場合には、証明書のローテーションが行われ、各ノードに 3 つ以上の証明書が存在するようになります。これらの証明書すべてを承認する必要があります。クライアントの CSR が承認された後に、Kubelet は提供証明書のセカンダリー CSR を作成します。これには、手動の承認が必要になります。次に、後続の提供証明書の更新要求は、Kubelet が同じパラメーターを持つ新規証明書を要求する場合に

machine-approverによって自動的に承認されます。注記ベアメタルおよび他の user-provisioned infrastructure などのマシン API ではないプラットフォームで実行されているクラスターの場合、kubelet 提供証明書要求 (CSR) を自動的に承認する方法を実装する必要があります。要求が承認されない場合、API サーバーが kubelet に接続する際に提供証明書が必須であるため、

oc exec、oc rsh、およびoc logsコマンドは正常に実行できません。Kubelet エンドポイントにアクセスする操作には、この証明書の承認が必要です。この方法は新規 CSR の有無を監視し、CSR がsystem:nodeまたはsystem:adminグループのnode-bootstrapperサービスアカウントによって提出されていることを確認し、ノードの ID を確認します。それらを個別に承認するには、それぞれの有効な CSR に以下のコマンドを実行します。

$ oc adm certificate approve <csr_name>1 - 1

<csr_name>は、現行の CSR のリストからの CSR の名前です。

すべての保留中の CSR を承認するには、以下のコマンドを実行します。

$ oc get csr -o go-template='{{range .items}}{{if not .status}}{{.metadata.name}}{{"\n"}}{{end}}{{end}}' | xargs --no-run-if-empty oc adm certificate approve注記一部の Operator は、一部の CSR が承認されるまで利用できない可能性があります。

クライアント要求が承認されたら、クラスターに追加した各マシンのサーバー要求を確認する必要があります。

$ oc get csr出力例

NAME AGE REQUESTOR CONDITION csr-bfd72 5m26s system:node:ip-10-0-50-126.us-east-2.compute.internal Pending csr-c57lv 5m26s system:node:ip-10-0-95-157.us-east-2.compute.internal Pending ...残りの CSR が承認されず、それらが

Pendingステータスにある場合、クラスターマシンの CSR を承認します。それらを個別に承認するには、それぞれの有効な CSR に以下のコマンドを実行します。

$ oc adm certificate approve <csr_name>1 - 1

<csr_name>は、現行の CSR のリストからの CSR の名前です。

すべての保留中の CSR を承認するには、以下のコマンドを実行します。

$ oc get csr -o go-template='{{range .items}}{{if not .status}}{{.metadata.name}}{{"\n"}}{{end}}{{end}}' | xargs oc adm certificate approve

すべてのクライアントおよびサーバーの CSR が承認された後に、マシンのステータスが

Readyになります。以下のコマンドを実行して、これを確認します。$ oc get nodes出力例

NAME STATUS ROLES AGE VERSION master-0 Ready master 73m v1.27.3 master-1 Ready master 73m v1.27.3 master-2 Ready master 74m v1.27.3 worker-0 Ready worker 11m v1.27.3 worker-1 Ready worker 11m v1.27.3注記サーバー CSR の承認後にマシンが

Readyステータスに移行するまでに数分の時間がかかる場合があります。

関連情報

- CSR の詳細は、Certificate Signing Requests を参照してください。

4.7. RHEL KVM を使用した IBM Z および IBM LinuxONE 上でマルチアーキテクチャーのコンピュートマシンを含むクラスターを作成する

RHEL KVM を使用して IBM Z® および IBM® LinuxONE (s390x) 上のマルチアーキテクチャーコンピュートマシンでクラスターを作成するには、既存の単一アーキテクチャー x86_64 クラスターが必要です。その後、s390x コンピュートマシンを OpenShift Container Platform クラスターに追加できます。

s390x ノードをクラスターに追加する前に、クラスターをマルチアーキテクチャーペイロードを使用するクラスターにアップグレードする必要があります。マルチアーキテクチャーペイロードへの移行の詳細は、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 を参照してください。

次の手順では、RHEL KVM インスタンスを使用して RHCOS コンピュートマシンを作成する方法を説明します。これにより、s390x ノードをクラスターに追加し、マルチアーキテクチャーのコンピュートマシンを含むクラスターをデプロイメントできるようになります。

4.7.1. クラスターの互換性の確認

異なるアーキテクチャーのコンピュートノードをクラスターに追加する前に、クラスターがマルチアーキテクチャー互換であることを確認する必要があります。

前提条件

-

OpenShift CLI (

oc) がインストールされている。

手順

次のコマンドを実行すると、クラスターがアーキテクチャーペイロードを使用していることを確認できます。

$ oc adm release info -o jsonpath="{ .metadata.metadata}"

検証

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用しています。

{ "release.openshift.io/architecture": "multi", "url": "https://access.redhat.com/errata/<errata_version>" }その後、クラスターへのマルチアーキテクチャーコンピュートノードの追加を開始できます。

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用していません。

{ "url": "https://access.redhat.com/errata/<errata_version>" }重要クラスターを、マルチアーキテクチャーコンピュートマシンをサポートするクラスターに移行するには、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 の手順に従ってください。

4.7.2. virt-install を使用した RHCOS マシンの作成

virt-install を使用すると、クラスター用にさらに Red Hat Enterprise Linux CoreOS (RHCOS) コンピュートマシンを作成できます。

前提条件

- この手順では RHEL KVM ホストと呼ばれる、KVM を使用する RHEL 8.7 以降で実行されている少なくとも 1 つの LPAR がある。

- KVM/QEMU ハイパーバイザーが RHEL KVM ホストにインストーされている

- ノードのホスト名および逆引き参照を実行できるドメインネームサーバー (DNS) がある。

- HTTP または HTTPS サーバーが設定されている。

手順

UDP アグリゲーションを無効にします。

現在、UDP アグリゲーションは IBM Z® ではサポートされておらず、

x86_64コントロールプレーンと追加のs390xコンピュートマシンを備えたマルチアーキテクチャーコンピュートクラスターでは自動的に非アクティブ化されません。追加のコンピュートノードがクラスターに正しく追加されるようにするには、UDP アグリゲーションを手動で無効にする必要があります。次の内容を含む YAML ファイル

udp-aggregation-config.yamlを作成します。apiVersion: v1 kind: ConfigMap data: disable-udp-aggregation: "true" metadata: name: udp-aggregation-config namespace: openshift-network-operator次のコマンドを実行して、ConfigMap リソースを作成します。

$ oc create -f udp-aggregation-config.yaml

次のコマンドを実行して、クラスターから Ignition 設定ファイルを抽出します。

$ oc extract -n openshift-machine-api secret/worker-user-data-managed --keys=userData --to=- > worker.ign-

クラスターからエクスポートした

worker.ignIgnition 設定ファイルを HTTP サーバーにアップロードします。このファイルの URL をメモします。 Ignition ファイルが URL で利用可能であることを検証できます。次の例では、コンピュートノードの Ignition 設定ファイルを取得します。

$ curl -k http://<HTTP_server>/worker.ign次のコマンドを実行して、RHEL ライブ

kernel、initramfs、およびrootfsファイルをダウンロードします。$ curl -LO $(oc -n openshift-machine-config-operator get configmap/coreos-bootimages -o jsonpath='{.data.stream}' \ | jq -r '.architectures.s390x.artifacts.metal.formats.pxe.kernel.location')$ curl -LO $(oc -n openshift-machine-config-operator get configmap/coreos-bootimages -o jsonpath='{.data.stream}' \ | jq -r '.architectures.s390x.artifacts.metal.formats.pxe.initramfs.location')$ curl -LO $(oc -n openshift-machine-config-operator get configmap/coreos-bootimages -o jsonpath='{.data.stream}' \ | jq -r '.architectures.s390x.artifacts.metal.formats.pxe.rootfs.location')-

virt-installを起動する前に、ダウンロードした RHEL ライブのkernelファイル、initramfsファイル、およびrootfsファイルを HTTP または HTTPS サーバーに移動します。 RHEL

kernel、initramfs、および Ignition ファイル、新規ディスクイメージ、および調整された parm 引数を使用して、新規 KVM ゲストノードを作成します。$ virt-install \ --connect qemu:///system \ --name <vm_name> \ --autostart \ --os-variant rhel9.2 \1 --cpu host \ --vcpus <vcpus> \ --memory <memory_mb> \ --disk <vm_name>.qcow2,size=<image_size> \ --network network=<virt_network_parm> \ --location <media_location>,kernel=<rhcos_kernel>,initrd=<rhcos_initrd> \2 --extra-args "rd.neednet=1" \ --extra-args "coreos.inst.install_dev=/dev/vda" \ --extra-args "coreos.inst.ignition_url=<worker_ign>" \3 --extra-args "coreos.live.rootfs_url=<rhcos_rootfs>" \4 --extra-args "ip=<ip>::<default_gateway>:<subnet_mask_length>:<hostname>::none:<MTU>" \5 --extra-args "nameserver=<dns>" \ --extra-args "console=ttysclp0" \ --noautoconsole \ --wait- 1

os-variantには、RHCOS コンピュートマシンの RHEL バージョンを指定します。rhel9.2が推奨バージョンです。オペレーティングシステムのサポートされている RHEL バージョンを照会するには、次のコマンドを実行します。$ osinfo-query os -f short-id注記os-variantでは大文字と小文字が区別されます。- 2

--locationには、HTTP サーバーまたは HTTPS サーバーのカーネル/initrd の場所を指定します。- 3

coreos.inst.ignition_url=には、マシンロールのworker.ignIgnition ファイルを指定します。HTTP プロトコルおよび HTTPS プロトコルのみがサポートされます。- 4

coreos.live.rootfs_url=の場合、起動しているkernelおよびinitramfsの一致する rootfs アーティファクトを指定します。HTTP プロトコルおよび HTTPS プロトコルのみがサポートされます。- 5

- オプション:

hostnameには、クライアントマシンの完全修飾ホスト名を指定します。

注記HAProxy をロードバランサーとして使用している場合は、

/etc/haproxy/haproxy.cfg設定ファイル内のingress-router-443およびingress-router-80の HAProxy ルールを更新します。- 継続してクラスター用の追加のコンピュートマシンを作成します。

4.7.3. マシンの証明書署名要求の承認

マシンをクラスターに追加する際に、追加したそれぞれのマシンに対して 2 つの保留状態の証明書署名要求 (CSR) が生成されます。これらの CSR が承認されていることを確認するか、必要な場合はそれらを承認してください。最初にクライアント要求を承認し、次にサーバー要求を承認する必要があります。

前提条件

- マシンがクラスターに追加されています。

手順

クラスターがマシンを認識していることを確認します。

$ oc get nodes出力例

NAME STATUS ROLES AGE VERSION master-0 Ready master 63m v1.27.3 master-1 Ready master 63m v1.27.3 master-2 Ready master 64m v1.27.3出力には作成したすべてのマシンがリスト表示されます。

注記上記の出力には、一部の CSR が承認されるまで、ワーカーノード (ワーカーノードとも呼ばれる) が含まれない場合があります。

保留中の証明書署名要求 (CSR) を確認し、クラスターに追加したそれぞれのマシンのクライアントおよびサーバー要求に

PendingまたはApprovedステータスが表示されていることを確認します。$ oc get csr出力例

NAME AGE REQUESTOR CONDITION csr-8b2br 15m system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending csr-8vnps 15m system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending ...この例では、2 つのマシンがクラスターに参加しています。このリストにはさらに多くの承認された CSR が表示される可能性があります。

追加したマシンの保留中の CSR すべてが

Pendingステータスになった後に CSR が承認されない場合には、クラスターマシンの CSR を承認します。注記CSR のローテーションは自動的に実行されるため、クラスターにマシンを追加後 1 時間以内に CSR を承認してください。1 時間以内に承認しない場合には、証明書のローテーションが行われ、各ノードに 3 つ以上の証明書が存在するようになります。これらの証明書すべてを承認する必要があります。クライアントの CSR が承認された後に、Kubelet は提供証明書のセカンダリー CSR を作成します。これには、手動の承認が必要になります。次に、後続の提供証明書の更新要求は、Kubelet が同じパラメーターを持つ新規証明書を要求する場合に

machine-approverによって自動的に承認されます。注記ベアメタルおよび他の user-provisioned infrastructure などのマシン API ではないプラットフォームで実行されているクラスターの場合、kubelet 提供証明書要求 (CSR) を自動的に承認する方法を実装する必要があります。要求が承認されない場合、API サーバーが kubelet に接続する際に提供証明書が必須であるため、

oc exec、oc rsh、およびoc logsコマンドは正常に実行できません。Kubelet エンドポイントにアクセスする操作には、この証明書の承認が必要です。この方法は新規 CSR の有無を監視し、CSR がsystem:nodeまたはsystem:adminグループのnode-bootstrapperサービスアカウントによって提出されていることを確認し、ノードの ID を確認します。それらを個別に承認するには、それぞれの有効な CSR に以下のコマンドを実行します。

$ oc adm certificate approve <csr_name>1 - 1

<csr_name>は、現行の CSR のリストからの CSR の名前です。

すべての保留中の CSR を承認するには、以下のコマンドを実行します。

$ oc get csr -o go-template='{{range .items}}{{if not .status}}{{.metadata.name}}{{"\n"}}{{end}}{{end}}' | xargs --no-run-if-empty oc adm certificate approve注記一部の Operator は、一部の CSR が承認されるまで利用できない可能性があります。

クライアント要求が承認されたら、クラスターに追加した各マシンのサーバー要求を確認する必要があります。

$ oc get csr出力例

NAME AGE REQUESTOR CONDITION csr-bfd72 5m26s system:node:ip-10-0-50-126.us-east-2.compute.internal Pending csr-c57lv 5m26s system:node:ip-10-0-95-157.us-east-2.compute.internal Pending ...残りの CSR が承認されず、それらが

Pendingステータスにある場合、クラスターマシンの CSR を承認します。それらを個別に承認するには、それぞれの有効な CSR に以下のコマンドを実行します。

$ oc adm certificate approve <csr_name>1 - 1

<csr_name>は、現行の CSR のリストからの CSR の名前です。

すべての保留中の CSR を承認するには、以下のコマンドを実行します。

$ oc get csr -o go-template='{{range .items}}{{if not .status}}{{.metadata.name}}{{"\n"}}{{end}}{{end}}' | xargs oc adm certificate approve

すべてのクライアントおよびサーバーの CSR が承認された後に、マシンのステータスが

Readyになります。以下のコマンドを実行して、これを確認します。$ oc get nodes出力例

NAME STATUS ROLES AGE VERSION master-0 Ready master 73m v1.27.3 master-1 Ready master 73m v1.27.3 master-2 Ready master 74m v1.27.3 worker-0 Ready worker 11m v1.27.3 worker-1 Ready worker 11m v1.27.3注記サーバー CSR の承認後にマシンが

Readyステータスに移行するまでに数分の時間がかかる場合があります。

関連情報

- CSR の詳細は、Certificate Signing Requests を参照してください。

4.8. IBM Power 上でマルチアーキテクチャーのコンピュートマシンを含むクラスターを作成する

IBM Power® (ppc64le) 上でマルチアーキテクチャーのコンピュートマシンを含むクラスターを作成するには、既存の単一アーキテクチャー (x86_64) クラスターが必要です。その後、ppc64le コンピュートマシンを OpenShift Container Platform クラスターに追加できます。

ppc64le ノードをクラスターに追加する前に、クラスターをマルチアーキテクチャーペイロードを使用するクラスターにアップグレードする必要があります。マルチアーキテクチャーペイロードへの移行の詳細は、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 を参照してください。

次の手順では、ISO イメージまたはネットワーク PXE ブートを使用して RHCOS コンピューティングマシンを作成する方法を説明します。これにより、ppc64le ノードをクラスターに追加し、マルチアーキテクチャーのコンピュートマシンを含むクラスターをデプロイできるようになります。

4.8.1. クラスターの互換性の確認

異なるアーキテクチャーのコンピュートノードをクラスターに追加する前に、クラスターがマルチアーキテクチャー互換であることを確認する必要があります。

前提条件

-

OpenShift CLI (

oc) がインストールされている。

複数のアーキテクチャーを使用する場合、OpenShift Container Platform ノードのホストは同じストレージレイヤーを共有する必要があります。同じストレージレイヤーがない場合は、nfs-provisioner などのストレージプロバイダーを使用します。

コンピュートプレーンとコントロールプレーン間のネットワークホップ数をできる限り制限する必要があります。

手順

次のコマンドを実行すると、クラスターがアーキテクチャーペイロードを使用していることを確認できます。

$ oc adm release info -o jsonpath="{ .metadata.metadata}"

検証

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用しています。

{ "release.openshift.io/architecture": "multi", "url": "https://access.redhat.com/errata/<errata_version>" }その後、クラスターへのマルチアーキテクチャーコンピュートノードの追加を開始できます。

次の出力が表示された場合、クラスターはマルチアーキテクチャーペイロードを使用していません。

{ "url": "https://access.redhat.com/errata/<errata_version>" }重要クラスターを、マルチアーキテクチャーコンピュートマシンをサポートするクラスターに移行するには、マルチアーキテクチャーのコンピュートマシンを含むクラスターへの移行 の手順に従ってください。

4.8.2. ISO イメージを使用した RHCOS マシンの作成

ISO イメージを使用して、クラスターの追加の Red Hat Enterprise Linux CoreOS (RHCOS) コンピュートマシンを作成できます。

前提条件

- クラスターのコンピュートマシンの Ignition 設定ファイルの URL を取得します。このファイルがインストール時に HTTP サーバーにアップロードされている必要があります。

-

OpenShift CLI (

oc) がインストールされている。

手順

次のコマンドを実行して、クラスターから Ignition 設定ファイルを抽出します。

$ oc extract -n openshift-machine-api secret/worker-user-data-managed --keys=userData --to=- > worker.ign-

クラスターからエクスポートした

worker.ignIgnition 設定ファイルを HTTP サーバーにアップロードします。これらのファイルの URL をメモします。 Ignition ファイルが URL で利用可能であることを検証できます。次の例では、コンピュートノードの Ignition 設定ファイルを取得します。

$ curl -k http://<HTTP_server>/worker.ign次のコマンドを実行すると、新しいマシンを起動するための ISO イメージにアクセスできます。

RHCOS_VHD_ORIGIN_URL=$(oc -n openshift-machine-config-operator get configmap/coreos-bootimages -o jsonpath='{.data.stream}' | jq -r '.architectures.<architecture>.artifacts.metal.formats.iso.disk.location')ISO ファイルを使用して、追加のコンピュートマシンに RHCOS をインストールします。クラスターのインストール前にマシンを作成する際に使用したのと同じ方法を使用します。

- ディスクに ISO イメージを書き込み、これを直接起動します。

- LOM インターフェイスで ISO リダイレクトを使用します。

オプションを指定したり、ライブ起動シーケンスを中断したりせずに、RHCOS ISO イメージを起動します。インストーラーが RHCOS ライブ環境でシェルプロンプトを起動するのを待ちます。

注記RHCOS インストールの起動プロセスを中断して、カーネル引数を追加できます。ただし、この ISO 手順では、カーネル引数を追加する代わりに、次の手順で概説するように

coreos-installerコマンドを使用する必要があります。coreos-installerコマンドを実行し、インストール要件を満たすオプションを指定します。少なくとも、ノードタイプの Ignition 設定ファイルを参照する URL と、インストール先のデバイスを指定する必要があります。$ sudo coreos-installer install --ignition-url=http://<HTTP_server>/<node_type>.ign <device> --ignition-hash=sha512-<digest>1 2 注記TLS を使用する HTTPS サーバーを使用して Ignition 設定ファイルを提供する場合は、

coreos-installerを実行する前に、内部認証局 (CA) をシステムのトラストストアに追加できます。以下の例では、

/dev/sdaデバイスへのコンピュートノードのインストールを初期化します。コンピュートノードの Ignition 設定ファイルは、IP アドレス 192.168.1.2 で HTTP Web サーバーから取得されます。$ sudo coreos-installer install --ignition-url=http://192.168.1.2:80/installation_directory/worker.ign /dev/sda --ignition-hash=sha512-a5a2d43879223273c9b60af66b44202a1d1248fc01cf156c46d4a79f552b6bad47bc8cc78ddf0116e80c59d2ea9e32ba53bc807afbca581aa059311def2c3e3bマシンのコンソールで RHCOS インストールの進捗を監視します。

重要OpenShift Container Platform のインストールを開始する前に、各ノードでインストールが成功していることを確認します。インストールプロセスを監視すると、発生する可能性のある RHCOS インストールの問題の原因を特定する上でも役立ちます。

- 継続してクラスター用の追加のコンピュートマシンを作成します。

4.8.3. PXE または iPXE ブートによる RHCOS マシンの作成

PXE または iPXE ブートを使用して、ベアメタルクラスターの追加の Red Hat Enterprise Linux CoreOS (RHCOS) コンピュートマシンを作成できます。

前提条件

- クラスターのコンピュートマシンの Ignition 設定ファイルの URL を取得します。このファイルがインストール時に HTTP サーバーにアップロードされている必要があります。

-

クラスターのインストール時に HTTP サーバーにアップロードした RHCOS ISO イメージ、圧縮されたメタル BIOS、

kernel、およびinitramfsファイルの URL を取得します。 - インストール時に OpenShift Container Platform クラスターのマシンを作成するために使用した PXE ブートインフラストラクチャーにアクセスできる必要があります。RHCOS のインストール後にマシンはローカルディスクから起動する必要があります。

-

UEFI を使用する場合、OpenShift Container Platform のインストール時に変更した

grub.confファイルにアクセスできます。

手順

RHCOS イメージの PXE または iPXE インストールが正常に行われていることを確認します。

PXE の場合:

DEFAULT pxeboot TIMEOUT 20 PROMPT 0 LABEL pxeboot KERNEL http://<HTTP_server>/rhcos-<version>-live-kernel-<architecture>1 APPEND initrd=http://<HTTP_server>/rhcos-<version>-live-initramfs.<architecture>.img coreos.inst.install_dev=/dev/sda coreos.inst.ignition_url=http://<HTTP_server>/worker.ign coreos.live.rootfs_url=http://<HTTP_server>/rhcos-<version>-live-rootfs.<architecture>.img2 - 1

- HTTP サーバーにアップロードしたライブ

kernelファイルの場所を指定します。 - 2

- HTTP サーバーにアップロードした RHCOS ファイルの場所を指定します。

initrdパラメーターはライブinitramfsファイルの場所であり、coreos.inst.ignition_urlパラメーター値はワーカー Ignition 設定ファイルの場所であり、coreos.live.rootfs_urlパラメーター値はライブrootfsファイルの場所になります。coreos.inst.ignition_urlおよびcoreos.live.rootfs_urlパラメーターは HTTP および HTTPS のみをサポートします。

注記この設定では、グラフィカルコンソールを使用するマシンでシリアルコンソールアクセスを有効にしません。別のコンソールを設定するには、

APPEND行に 1 つ以上のconsole=引数を追加します。たとえば、console=tty0 console=ttyS0を追加して、最初の PC シリアルポートをプライマリーコンソールとして、グラフィカルコンソールをセカンダリーコンソールとして設定します。詳細は、How does one set up a serial terminal and/or console in Red Hat Enterprise Linux? を参照してください。iPXE (

x86_64+ppc64le) の場合:kernel http://<HTTP_server>/rhcos-<version>-live-kernel-<architecture> initrd=main coreos.live.rootfs_url=http://<HTTP_server>/rhcos-<version>-live-rootfs.<architecture>.img coreos.inst.install_dev=/dev/sda coreos.inst.ignition_url=http://<HTTP_server>/worker.ign1 2 initrd --name main http://<HTTP_server>/rhcos-<version>-live-initramfs.<architecture>.img3 boot- 1

- HTTP サーバーにアップロードした RHCOS ファイルの場所を指定します。

kernelパラメーター値はkernelファイルの場所であり、initrd=main引数は UEFI システムでの起動に必要であり、coreos.live.rootfs_urlパラメーター値はワーカー Ignition 設定ファイルの場所であり、coreos.inst.ignition_urlパラメーター値はrootfsのライブファイルの場所です。 - 2

- 複数の NIC を使用する場合、

ipオプションに単一インターフェイスを指定します。たとえば、eno1という名前の NIC で DHCP を使用するには、ip=eno1:dhcpを設定します。 - 3

- HTTP サーバーにアップロードした

initramfsファイルの場所を指定します。

注記この設定では、グラフィカルコンソールを備えたマシンでのシリアルコンソールアクセスは有効になりません。別のコンソールを設定するには、

kernel行に 1 つ以上のconsole=引数を追加します。たとえば、console=tty0 console=ttyS0を追加して、最初の PC シリアルポートをプライマリーコンソールとして、グラフィカルコンソールをセカンダリーコンソールとして設定します。詳細は、How does one set up a serial terminal and/or console in Red Hat Enterprise Linux? と、「高度な RHCOS インストール設定」セクションの「PXE および ISO インストール用シリアルコンソールの有効化」を参照してください。注記ppc64leアーキテクチャーで CoreOSkernelをネットワークブートするには、IMAGE_GZIPオプションが有効になっているバージョンの iPXE ビルドを使用する必要があります。iPXE のIMAGE_GZIPオプション を参照してください。ppc64le上の PXE (第 2 段階として UEFI と GRUB を使用) の場合:menuentry 'Install CoreOS' { linux rhcos-<version>-live-kernel-<architecture> coreos.live.rootfs_url=http://<HTTP_server>/rhcos-<version>-live-rootfs.<architecture>.img coreos.inst.install_dev=/dev/sda coreos.inst.ignition_url=http://<HTTP_server>/worker.ign1 2 initrd rhcos-<version>-live-initramfs.<architecture>.img3 }- 1

- HTTP/TFTP サーバーにアップロードした RHCOS ファイルの場所を指定します。

kernelパラメーター値は、TFTP サーバー上のkernelファイルの場所になります。coreos.live.rootfs_urlパラメーター値はrootfsファイルの場所であり、coreos.inst.ignition_urlパラメーター値は HTTP サーバー上のブートストラップ Ignition 設定ファイルの場所になります。 - 2

- 複数の NIC を使用する場合、

ipオプションに単一インターフェイスを指定します。たとえば、eno1という名前の NIC で DHCP を使用するには、ip=eno1:dhcpを設定します。 - 3

- TFTP サーバーにアップロードした

initramfsファイルの場所を指定します。

- PXE または iPXE インフラストラクチャーを使用して、クラスターに必要なコンピュートマシンを作成します。

4.8.4. マシンの証明書署名要求の承認

マシンをクラスターに追加する際に、追加したそれぞれのマシンに対して 2 つの保留状態の証明書署名要求 (CSR) が生成されます。これらの CSR が承認されていることを確認するか、必要な場合はそれらを承認してください。最初にクライアント要求を承認し、次にサーバー要求を承認する必要があります。

前提条件

- マシンがクラスターに追加されています。

手順

クラスターがマシンを認識していることを確認します。

$ oc get nodes出力例

NAME STATUS ROLES AGE VERSION master-0 Ready master 63m v1.27.3 master-1 Ready master 63m v1.27.3 master-2 Ready master 64m v1.27.3出力には作成したすべてのマシンがリスト表示されます。

注記上記の出力には、一部の CSR が承認されるまで、ワーカーノード (ワーカーノードとも呼ばれる) が含まれない場合があります。

保留中の証明書署名要求 (CSR) を確認し、クラスターに追加したそれぞれのマシンのクライアントおよびサーバー要求に

PendingまたはApprovedステータスが表示されていることを確認します。$ oc get csr出力例

NAME AGE REQUESTOR CONDITION csr-8b2br 15m system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending csr-8vnps 15m system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending ...この例では、2 つのマシンがクラスターに参加しています。このリストにはさらに多くの承認された CSR が表示される可能性があります。

追加したマシンの保留中の CSR すべてが

Pendingステータスになった後に CSR が承認されない場合には、クラスターマシンの CSR を承認します。注記CSR のローテーションは自動的に実行されるため、クラスターにマシンを追加後 1 時間以内に CSR を承認してください。1 時間以内に承認しない場合には、証明書のローテーションが行われ、各ノードに 3 つ以上の証明書が存在するようになります。これらの証明書すべてを承認する必要があります。クライアントの CSR が承認された後に、Kubelet は提供証明書のセカンダリー CSR を作成します。これには、手動の承認が必要になります。次に、後続の提供証明書の更新要求は、Kubelet が同じパラメーターを持つ新規証明書を要求する場合に

machine-approverによって自動的に承認されます。注記ベアメタルおよび他の user-provisioned infrastructure などのマシン API ではないプラットフォームで実行されているクラスターの場合、kubelet 提供証明書要求 (CSR) を自動的に承認する方法を実装する必要があります。要求が承認されない場合、API サーバーが kubelet に接続する際に提供証明書が必須であるため、

oc exec、oc rsh、およびoc logsコマンドは正常に実行できません。Kubelet エンドポイントにアクセスする操作には、この証明書の承認が必要です。この方法は新規 CSR の有無を監視し、CSR がsystem:nodeまたはsystem:adminグループのnode-bootstrapperサービスアカウントによって提出されていることを確認し、ノードの ID を確認します。それらを個別に承認するには、それぞれの有効な CSR に以下のコマンドを実行します。

$ oc adm certificate approve <csr_name>1 - 1

<csr_name>は、現行の CSR のリストからの CSR の名前です。

すべての保留中の CSR を承認するには、以下のコマンドを実行します。

$ oc get csr -o go-template='{{range .items}}{{if not .status}}{{.metadata.name}}{{"\n"}}{{end}}{{end}}' | xargs --no-run-if-empty oc adm certificate approve注記一部の Operator は、一部の CSR が承認されるまで利用できない可能性があります。

クライアント要求が承認されたら、クラスターに追加した各マシンのサーバー要求を確認する必要があります。

$ oc get csr出力例

NAME AGE REQUESTOR CONDITION csr-bfd72 5m26s system:node:ip-10-0-50-126.us-east-2.compute.internal Pending csr-c57lv 5m26s system:node:ip-10-0-95-157.us-east-2.compute.internal Pending ...残りの CSR が承認されず、それらが

Pendingステータスにある場合、クラスターマシンの CSR を承認します。それらを個別に承認するには、それぞれの有効な CSR に以下のコマンドを実行します。

$ oc adm certificate approve <csr_name>1 - 1

<csr_name>は、現行の CSR のリストからの CSR の名前です。

すべての保留中の CSR を承認するには、以下のコマンドを実行します。

$ oc get csr -o go-template='{{range .items}}{{if not .status}}{{.metadata.name}}{{"\n"}}{{end}}{{end}}' | xargs oc adm certificate approve

すべてのクライアントおよびサーバーの CSR が承認された後に、マシンのステータスが

Readyになります。以下のコマンドを実行して、これを確認します。$ oc get nodes -o wideNAME STATUS ROLES AGE VERSION INTERNAL-IP EXTERNAL-IP OS-IMAGE KERNEL-VERSION CONTAINER-RUNTIME worker-0-ppc64le Ready worker 42d v1.28.2+e3ba6d9 192.168.200.21 <none> Red Hat Enterprise Linux CoreOS 415.92.202309261919-0 (Plow) 5.14.0-284.34.1.el9_2.ppc64le cri-o://1.28.1-3.rhaos4.15.gitb36169e.el9 worker-1-ppc64le Ready worker 42d v1.28.2+e3ba6d9 192.168.200.20 <none> Red Hat Enterprise Linux CoreOS 415.92.202309261919-0 (Plow) 5.14.0-284.34.1.el9_2.ppc64le cri-o://1.28.1-3.rhaos4.15.gitb36169e.el9 master-0-x86 Ready control-plane,master 75d v1.28.2+e3ba6d9 10.248.0.38 10.248.0.38 Red Hat Enterprise Linux CoreOS 415.92.202309261919-0 (Plow) 5.14.0-284.34.1.el9_2.x86_64 cri-o://1.28.1-3.rhaos4.15.gitb36169e.el9 master-1-x86 Ready control-plane,master 75d v1.28.2+e3ba6d9 10.248.0.39 10.248.0.39 Red Hat Enterprise Linux CoreOS 415.92.202309261919-0 (Plow) 5.14.0-284.34.1.el9_2.x86_64 cri-o://1.28.1-3.rhaos4.15.gitb36169e.el9 master-2-x86 Ready control-plane,master 75d v1.28.2+e3ba6d9 10.248.0.40 10.248.0.40 Red Hat Enterprise Linux CoreOS 415.92.202309261919-0 (Plow) 5.14.0-284.34.1.el9_2.x86_64 cri-o://1.28.1-3.rhaos4.15.gitb36169e.el9 worker-0-x86 Ready worker 75d v1.28.2+e3ba6d9 10.248.0.43 10.248.0.43 Red Hat Enterprise Linux CoreOS 415.92.202309261919-0 (Plow) 5.14.0-284.34.1.el9_2.x86_64 cri-o://1.28.1-3.rhaos4.15.gitb36169e.el9 worker-1-x86 Ready worker 75d v1.28.2+e3ba6d9 10.248.0.44 10.248.0.44 Red Hat Enterprise Linux CoreOS 415.92.202309261919-0 (Plow) 5.14.0-284.34.1.el9_2.x86_64 cri-o://1.28.1-3.rhaos4.15.gitb36169e.el9注記サーバー CSR の承認後にマシンが

Readyステータスに移行するまでに数分の時間がかかる場合があります。

関連情報

- CSR の詳細は、Certificate Signing Requests を参照してください。

4.9. マルチアーキテクチャーのコンピュートマシンを使用したクラスターの管理

4.9.1. マルチアーキテクチャーのコンピュートマシンを使用したクラスター上でのワークロードのスケジュール設定

さまざまなアーキテクチャーのコンピュートノードを含むクラスターにワークロードをデプロイするには、クラスターの注意と監視が必要です。クラスターのノードに Pod を正常に配置するには、さらにアクションが必要な場合があります。

ノードアフィニティー、スケジューリング、テイント、許容範囲の詳細は、次のドキュメントを参照してください。

4.9.1.1. マルチアーキテクチャーノードのワークロードデプロイメントのサンプル

異なるアーキテクチャーのコンピュートノードを含むクラスター上でワークロードをスケジュールする前に、次の使用例を考慮してください。

- ノードアフィニティーを使用してノード上のワークロードをスケジュールする

イメージによってサポートされるアーキテクチャーを持つ一連のノード上でのみワークロードをスケジュールできるようにすることができ、Pod のテンプレート仕様で

spec.affinity.nodeAffinityフィールドを設定できます。特定のアーキテクチャーに設定された