ネットワークセキュリティー

OpenShift Container Platform におけるネットワークトラフィックの保護とネットワークポリシーの適用

概要

第1章 ネットワークポリシー API について

ネットワークポリシーは、クラスタースコープと namespace スコープの両方のネットワークポリシー API を使用して定義されます。これらのさまざまなレベルにわたってネットワークポリシーを定義することで、完全なマルチテナント分離を含む、クラスターの高度なネットワークセキュリティー設定を作成できます。

1.1. ネットワークポリシーとその範囲

- クラスタースコープのネットワークポリシー

クラスターおよびネットワーク管理者は、AdminNetworkPolicy を使用してクラスターレベルでネットワークポリシーを定義できます。AdminNetworkPolicy 機能は、

AdminNetworkPolicyAPI とBaselineAdminNetworkPolicyAPI の 2 つの API で構成されます。これらの API は、クラスター全体に適用できるルール、または namespace スコープのNetworkPolicyに委譲できるルールを設定するために使用されます。AdminNetworkPolicyAPI を使用して定義されたポリシーは、「許可」または「拒否」に設定されている場合、他のすべてのポリシータイプよりも優先されます。ただし、管理者は "Pass" を使用して、特定のポリシーの責任を namespace スコープのNetworkPolicyに委譲し、アプリケーション開発者と namespace テナントが、プロジェクトのネットワークセキュリティーの特定の側面を制御できるようにすることもできます。BaselineAdminNetworkPolicyAPI を使用して定義されたポリシーは、他のネットワークポリシーによってオーバーライドされない場合にのみ適用されます。AdminNetworkPolicyAPI を使用して、ネットワークポリシーの側面を namespace スコープのNetworkPolicyに委譲する場合は、BaselineAdminNetworkPolicyで適切な最小限の制限も定義する必要があります。これにより、namespace のNetworkPolicyが十分な保護を提供しない場合に、クラスターレベルでネットワークセキュリティーのベースラインレベルが確保されます。- namespace スコープのネットワークポリシー

-

アプリケーション開発者と namespace テナントは、

NetworkPolicyAPI を使用して、特定の namespace のネットワークポリシールールを定義できます。namespace のNetworkPolicy内のルールは、BaselineAdminNetworkPolicy API を使用して設定されたクラスター全体のルール、またはクラスター全体のAdminNetworkPolicyAPI から委譲または「渡された」クラスター全体のルールよりも優先されます。

1.2. ネットワークポリシーの評価と適用方法

ネットワーク接続が確立されると、ネットワークプロバイダー (デフォルト: OVN-Kubernetes) は、接続の詳細をネットワークポリシールールと照合して、接続の処理方法を決定します。

OVN-Kubernetes は、次の順序でネットワークポリシーオブジェクトに対する接続を評価します。

AdminNetworkPolicy 層で一致を確認します。

-

接続が

AllowまたはDenyルールに一致する場合、そのルールに従って評価を停止します。 -

接続が

Passルールに一致する場合は、NetworkPolicy 層に移動します。

-

接続が

NetworkPolicy 層で一致を確認します。

- 接続がルールに一致する場合、そのルールに従って評価を停止します。

- 一致するものが見つからない場合は、BaselineAdminNetworkPolicy 層に移動します。

- BaselineAdminNetworkPolicy 層の一致するルールに従います。

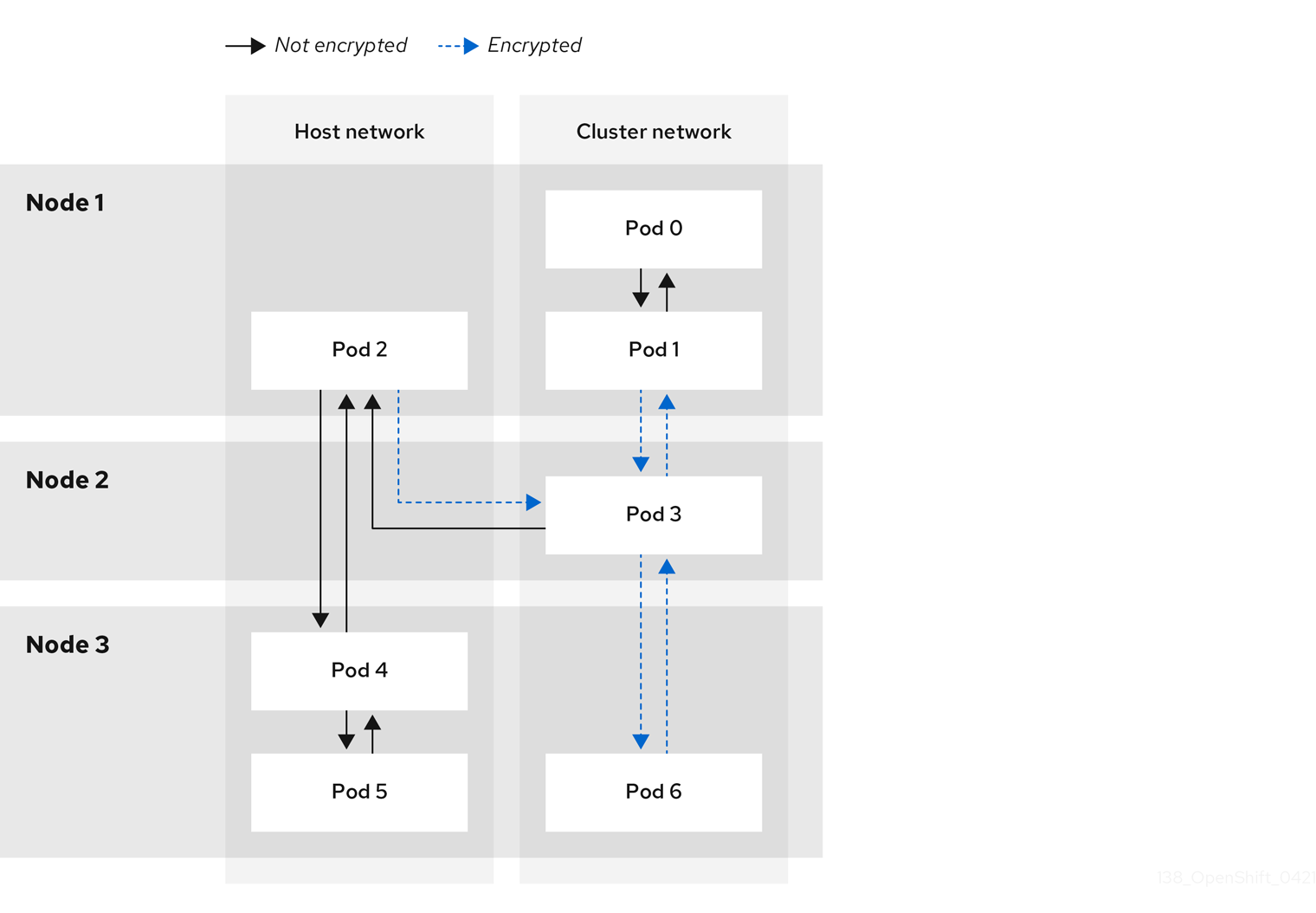

図1.1 OVN-Kubernetes によるネットワークポリシーの評価

1.3. AdminNetworkPolicy と NetworkPolicy カスタムリソースの主な違い

次の表は、クラスタースコープの AdminNetworkPolicy API と namespace スコープの NetworkPolicy API の主な違いを説明しています。

| ポリシーの要素 | AdminNetworkPolicy | NetworkPolicy |

|---|---|---|

| 対象ユーザー | クラスター管理者または同等の権限 | namespace の所有者 |

| スコープ | Cluster | namespace |

| トラフィックのドロップ |

明示的な |

ポリシー作成時に暗黙的に |

| トラフィックの委譲 |

| 該当なし。 |

| トラフィックの許可 |

明示的に | すべてのルールに対するデフォルトのアクションは allow です。 |

| ポリシー内のルールの優先順位 | ANP 内で表示される順序によって異なります。ルールの位置が高いほど、優先順位が高くなります。 | ルールは加算的です。 |

| ポリシーの優先順位 |

ANP 間では、 | ポリシー間にポリシー順序はありません。 |

| 機能の優先順位 | 最初に Tier 1 ACL を介して評価され、最後に BANP が Tier 3 ACL を介して評価されます。 | ANP の後、BANP の前に適用され、ACL の Tier 2 で評価されます。 |

| Pod 選択の一致 | namespace 間で異なるルールを適用できます。 | 1 つの namespace 内の Pod に異なるルールを適用できます。 |

| クラスターの Egress トラフィック |

|

受け入れられた CIDR 構文とともに |

| クラスター Ingress トラフィック | サポート対象外。 | サポート対象外。 |

| 完全修飾ドメイン名 (FQDN) ピアサポート | サポート対象外。 | サポート対象外。 |

| namespace セレクター |

|

|

第2章 管理ネットワークポリシー

2.1. OVN-Kubernetes AdminNetworkPolicy

2.1.1. AdminNetworkPolicy

AdminNetworkPolicy (ANP) は、クラスタースコープのカスタムリソース定義 (CRD) です。OpenShift Container Platform 管理者は、namespace を作成する前にネットワークポリシーを作成することで、ANP を使用してネットワークを保護できます。さらに、NetworkPolicy オブジェクトによってオーバーライドできないネットワークポリシーをクラスタースコープのレベルで作成できます。

AdminNetworkPolicy オブジェクトと NetworkPolicy オブジェクトの主な違いは、前者は管理者用でクラスタースコープであるのに対し、後者はテナント所有者用で namespace スコープであることです。

ANP を使用すると、管理者は以下を指定できます。

-

評価の順序を決定する

priority値。値が小さいほど優先度が高くなります。 - ポリシーが適用される namespace (または namespace のセット) で構成される Pod のセット。

-

subjectへのすべての Ingress トラフィックに適用される Ingress ルールのリスト。 -

subjectからのすべての Egress トラフィックに適用される Egress ルールのリスト。

2.1.1.1. AdminNetworkPolicy の例

例2.1 ANP の YAML ファイルの例

apiVersion: policy.networking.k8s.io/v1alpha1

kind: AdminNetworkPolicy

metadata:

name: sample-anp-deny-pass-rules

spec:

priority: 50

subject:

namespaces:

matchLabels:

kubernetes.io/metadata.name: example.name

ingress:

- name: "deny-all-ingress-tenant-1"

action: "Deny"

from:

- pods:

namespaceSelector:

matchLabels:

custom-anp: tenant-1

podSelector:

matchLabels:

custom-anp: tenant-1

egress:

- name: "pass-all-egress-to-tenant-1"

action: "Pass"

to:

- pods:

namespaceSelector:

matchLabels:

custom-anp: tenant-1

podSelector:

matchLabels:

custom-anp: tenant-1- 1

- ANP の名前を指定します。

- 2

spec.priorityフィールドは、0-99の値を受け入れ、クラスター内で最大 100 個の ANP をサポートします。範囲は最低値から最高値の順に読み取られるため、値が低いほど優先度が高くなります。同じ優先度で ANP を作成すると、どのポリシーが優先されるか保証されません。そのため、優先順位が意図したものになるように、異なる優先度で ANP を設定してください。- 3

- ANP リソースを適用する namespace を指定します。

- 4

- ANP には Ingress ルールと Egress ルールの両方があります。

spec.ingressフィールドの ANP ルールは、actionフィールドのPass、Deny、およびAllowの値を受け入れます。 - 5

ingress.nameの名前を指定します。- 6

namespaceSelector.matchLabelsによって選択された namespace 内の Pod を Ingress ピアとして選択するには、podSelector.matchLabelsを指定します。- 7

- ANP には、Ingress と Egress ルールの両方があります。

spec.egressフィールドの ANP ルールは、actionフィールドのPass、Deny、およびAllowの値を受け入れます。

2.1.1.2. ルールの AdminNetworkPolicy アクション

管理者は、AdminNetworkPolicy ルールの action フィールドに Allow、Deny、または Pass を設定できます。OVN-Kubernetes は階層型 ACL を使用してネットワークトラフィックルールを評価するため、ANP を使用すると、非常に強力なポリシールールを設定できます。このポリシールールを変更するには、管理者がルールを変更、削除するか、より高い優先度のルールを設定してオーバーライドする必要があります。

2.1.1.2.1. AdminNetworkPolicy の Allow の例

優先度 9 で定義されている次の ANP は、monitoring namespace からクラスター内の任意のテナント (他のすべての namespace) への Ingress トラフィックをすべて許可します。

例2.2 強力な Allow ANP の YAML ファイルの例

apiVersion: policy.networking.k8s.io/v1alpha1

kind: AdminNetworkPolicy

metadata:

name: allow-monitoring

spec:

priority: 9

subject:

namespaces: {} # Use the empty selector with caution because it also selects OpenShift namespaces as well.

ingress:

- name: "allow-ingress-from-monitoring"

action: "Allow"

from:

- namespaces:

matchLabels:

kubernetes.io/metadata.name: monitoring

# ...

これは、関係者全員がオーバーライドできない強力な Allow ANP の例です。テナントは、NetworkPolicy オブジェクトを使用してテナント自体の監視をブロックすることはできません。また、監視を実行するテナントが監視の対象を決定することもできません。

2.1.1.2.2. AdminNetworkPolicy の Deny の例

優先度 5 で定義されている次の ANP は、monitoring namespace から制限付きテナント (security: restricted ラベルを持つ namespace) への Ingress トラフィックをすべてブロックします。

例2.3 強力な Deny ANP の YAML ファイルの例

apiVersion: policy.networking.k8s.io/v1alpha1

kind: AdminNetworkPolicy

metadata:

name: block-monitoring

spec:

priority: 5

subject:

namespaces:

matchLabels:

security: restricted

ingress:

- name: "deny-ingress-from-monitoring"

action: "Deny"

from:

- namespaces:

matchLabels:

kubernetes.io/metadata.name: monitoring

# ...

これは、関係者全員がオーバーライドできない強力な Deny ANP です。制限付きテナントの所有者は、トラフィックの監視を許可する権限を自分自身に付与できません。また、インフラストラクチャーの監視サービスは、これらの機密性の高い namespace から何も収集できません。

強力な Allow の例と組み合わせると、block-monitoring ANP は (Allow の例よりも) 優先度の値が低いため優先順位が高くなり、これにより制限付きテナントが監視されることはなくなります。

2.1.1.2.3. AdminNetworkPolicy の Pass の例

優先度 7 で定義されている次の ANP は、monitoring namespace から内部インフラストラクチャーテナント (security: internal ラベルを持つ namespace) への Ingress トラフィックをすべて ACL の階層 2 に渡し、トラフィックが namespace の NetworkPolicy オブジェクトによって評価されるようにします。

例2.4 強力な Pass ANP の YAML ファイルの例

apiVersion: policy.networking.k8s.io/v1alpha1

kind: AdminNetworkPolicy

metadata:

name: pass-monitoring

spec:

priority: 7

subject:

namespaces:

matchLabels:

security: internal

ingress:

- name: "pass-ingress-from-monitoring"

action: "Pass"

from:

- namespaces:

matchLabels:

kubernetes.io/metadata.name: monitoring

# ...

この例は、テナント所有者によって定義された NetworkPolicy オブジェクトに決定を委譲する強力な Pass アクション ANP です。この pass-monitoring ANP により、internal セキュリティーレベルでグループ化されたすべてのテナント所有者は、インフラストラクチャーの監視サービスによって namespace スコープの NetworkPolicy オブジェクトを使用してメトリクスを収集する必要があるかどうかを選択できます。

2.2. OVN-Kubernetes BaselineAdminNetworkPolicy

2.2.1. BaselineAdminNetworkPolicy

BaselineAdminNetworkPolicy (BANP) は、クラスタースコープのカスタムリソース定義 (CRD) です。OpenShift Container Platform 管理者は、BANP を使用すると、NetworkPolicy オブジェクトを使用してユーザーが必要に応じてオーバーライドできるオプションのベースラインネットワークポリシールールを設定および適用できます。BANP のルールアクションは、allow または deny です。

BaselineAdminNetworkPolicy リソースは、クラスターのシングルトンオブジェクトであり、渡されたトラフィックポリシーがクラスター内のどの NetworkPolicy オブジェクトにも一致しない場合にガードレールポリシーとして使用できます。BANP は、クラスター内トラフィックをデフォルトでブロックするガードレールを提供するデフォルトのセキュリティーモデルとしても使用できます。その場合、ユーザーが NetworkPolicy オブジェクトを使用して既知のトラフィックを許可する必要があります。BANP リソースを作成するときは、名前として default を使用する必要があります。

BANP を使用すると、管理者は以下を指定できます。

-

一連の namespace または namespace で構成される

subject。 -

subjectへのすべての Ingress トラフィックに適用される Ingress ルールのリスト。 -

subjectからのすべての Egress トラフィックに適用される Egress ルールのリスト。

2.2.1.1. BaselineAdminNetworkPolicy の例

例2.5 BANP の YAML ファイルの例

apiVersion: policy.networking.k8s.io/v1alpha1

kind: BaselineAdminNetworkPolicy

metadata:

name: default

spec:

subject:

namespaces:

matchLabels:

kubernetes.io/metadata.name: example.name

ingress:

- name: "deny-all-ingress-from-tenant-1"

action: "Deny"

from:

- pods:

namespaceSelector:

matchLabels:

custom-banp: tenant-1

podSelector:

matchLabels:

custom-banp: tenant-1

egress:

- name: "allow-all-egress-to-tenant-1"

action: "Allow"

to:

- pods:

namespaceSelector:

matchLabels:

custom-banp: tenant-1

podSelector:

matchLabels:

custom-banp: tenant-1- 1

- BANP はシングルトンオブジェクトであるため、ポリシー名は

defaultにする必要があります。 - 2

- ANP を適用する namespace を指定します。

- 3

- BANP には Ingress ルールと Egress ルールの両方があります。

spec.ingressフィールドとspec.egressフィールドの BANP ルールは、actionフィールドのDenyとAllowの値を受け入れます。 - 4

ingress.nameの名前を指定します。- 5

- BANP リソースを適用する Pod の選択元の namespace を指定します。

- 6

- BANP リソースを適用する Pod の

podSelector.matchLabels名を指定します。

2.2.1.2. BaselineAdminNetworkPolicy の Deny の例

次の BANP シングルトンは、internal セキュリティーレベルのテナントに着信するすべての Ingress 監視トラフィックに対してデフォルトの拒否ポリシーを設定します。「AdminNetworkPolicy の Pass の例」と組み合わせると、この拒否ポリシーは、ANP pass-monitoring ポリシーによって渡されるすべての Ingress トラフィックに対するガードレールポリシーとして機能します。

例2.6 Deny ガードレールルールの YAML ファイルの例

apiVersion: policy.networking.k8s.io/v1alpha1

kind: BaselineAdminNetworkPolicy

metadata:

name: default

spec:

subject:

namespaces:

matchLabels:

security: internal

ingress:

- name: "deny-ingress-from-monitoring"

action: "Deny"

from:

- namespaces:

matchLabels:

kubernetes.io/metadata.name: monitoring

# ...

action フィールドに Pass 値を指定した AdminNetworkPolicy リソースを BaselineAdminNetworkPolicy リソースと組み合わせて使用すると、マルチテナントポリシーを作成できます。このマルチテナントポリシーを使用すると、あるテナントのアプリケーションの監視データを収集しながら、別のテナントのデータを収集しないことが可能になります。

管理者が「AdminNetworkPolicy の Pass アクションの例」と「BaselineAdminNetwork Policy の Deny の例」の両方を適用すると、BANP の前に評価される NetworkPolicy リソースを作成するかどうかをテナントが選択できるようになります。

たとえば、テナント 1 が Ingress トラフィックを監視する次の NetworkPolicy リソースを設定したとします。

例2.7 NetworkPolicy の例

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

name: allow-monitoring

namespace: tenant 1

spec:

podSelector:

policyTypes:

- Ingress

ingress:

- from:

- namespaceSelector:

matchLabels:

kubernetes.io/metadata.name: monitoring

# ...

この場合、テナント 1 のポリシーは、「AdminNetworkPolicy の Pass アクションの例」の後、security レベルが internal のテナントに着信する Ingress 監視トラフィックをすべて拒否する「BaselineAdminNetwork Policy の Deny の例」の前に評価されます。テナント 1 の NetworkPolicy オブジェクトを設定すると、テナント 1 はアプリケーションのデータを収集できるようになります。一方、NetworkPolicy オブジェクトが設定されていないテナント 2 は、データを収集できません。管理者はデフォルトでは内部のテナントを監視していませんでした。その代わりに BANP を作成し、テナントが NetworkPolicy オブジェクトを使用して BANP のデフォルト動作をオーバーライドできるようにしました。

2.3. ANP と BANP の監視

AdminNetworkPolicy および BaselineAdminNetworkPolicy リソースには、ポリシーの監視と管理に使用できるメトリクスがあります。メトリクスの詳細は、以下の表を参照してください。

2.3.1. AdminNetworkPolicy のメトリクス

| 名前 | 説明 | 詳細 |

|---|---|---|

|

| 該当なし |

クラスター内の |

|

| 該当なし |

クラスター内の |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

2.4. AdminNetworkPolicy の Egress ノードとネットワークピア

このセクションでは、nodes と networks のピアを説明します。管理者は、このセクションの例を使用して、クラスター内のノースバウンドトラフィックを制御するための AdminNetworkPolicy と BaselineAdminNetworkPolicy を設計できます。

2.4.1. AdminNetworkPolicy および BaselineAdminNetworkPolicy のノースバウンドトラフィック制御

ANP と BANP では、East-West トラフィック制御のサポートに加えて、管理者がクラスターから出るノースバウンドトラフィックや、ノードからクラスター内の他のノードに向かうトラフィックを制御することもできます。エンドユーザーは次のことができます。

-

nodesEgress ピアを使用してクラスターノードへの Egress トラフィック制御を実装する -

nodesまたはnetworksの Egress ピアを使用して Kubernetes API サーバーへの Egress トラフィック制御を実装する -

networksピアを使用してクラスター外の外部宛先への Egress トラフィック制御を実装する

ANP および BANP の場合、nodes と networks のピアは Egress ルールに対してのみ指定できます。

2.4.1.1. ノードピアを使用してクラスターノードへの Egress トラフィックを制御する

nodes ピアを使用すると、管理者は Pod からクラスター内のノードへの Egress トラフィックを制御できます。この利点は、クラスターにノードを追加したり、クラスターからノードを削除したりするときにポリシーを変更する必要がないことです。

次の例では、ノードセレクターピアを使用して、restricted、confidential、または internal レベルのセキュリティーを持つ任意の namespace によるポート 6443 上の Kubernetes API サーバーへの Egress トラフィックを許可します。また、セキュリティーレベルが restricted、confidential、または internal のいずれかである namespace からクラスター内のすべてのワーカーノードへのトラフィックも拒否します。

例2.8 nodes ピアを使用した ANP Allow Egress の例

apiVersion: policy.networking.k8s.io/v1alpha1

kind: AdminNetworkPolicy

metadata:

name: egress-security-allow

spec:

egress:

- action: Deny

to:

- nodes:

matchExpressions:

- key: node-role.kubernetes.io/worker

operator: Exists

- action: Allow

name: allow-to-kubernetes-api-server-and-engr-dept-pods

ports:

- portNumber:

port: 6443

protocol: TCP

to:

- nodes:

matchExpressions:

- key: node-role.kubernetes.io/control-plane

operator: Exists

- pods:

namespaceSelector:

matchLabels:

dept: engr

podSelector: {}

priority: 55

subject:

namespaces:

matchExpressions:

- key: security

operator: In

values:

- restricted

- confidential

- internal2.4.1.2. ネットワークピアを使用して外部の宛先への Egress トラフィックを制御する

クラスター管理者は、networks ピアで CIDR 範囲を使用し、Pod から networks フィールドで指定された CIDR 範囲内の IP アドレスで設定された宛先に送信される Egress トラフィックを制御するポリシーを適用できます。

以下の例では、networks ピアを使用し、ANP ポリシーと BANP ポリシーを組み合わせて出力トラフィックを制限します。

ANP および BANP の namespace フィールドで空のセレクター ({}) を使用する場合は注意が必要です。空のセレクターを使用する場合は、OpenShift namespace も選択します。

ANP または BANP Deny ルールで 0.0.0.0/0 の値を使用する場合は、Deny を 0.0.0.0/0 に設定する前に、必要な宛先に優先度の高い ANP Allow ルールを設定する必要があります。

例2.9 networks ピアを使用した ANP と BANP の例

apiVersion: policy.networking.k8s.io/v1alpha1

kind: AdminNetworkPolicy

metadata:

name: network-as-egress-peer

spec:

priority: 70

subject:

namespaces: {} # Use the empty selector with caution because it also selects OpenShift namespaces as well.

egress:

- name: "deny-egress-to-external-dns-servers"

action: "Deny"

to:

- networks:

- 8.8.8.8/32

- 8.8.4.4/32

- 208.67.222.222/32

ports:

- portNumber:

protocol: UDP

port: 53

- name: "allow-all-egress-to-intranet"

action: "Allow"

to:

- networks:

- 89.246.180.0/22

- 60.45.72.0/22

- name: "allow-all-intra-cluster-traffic"

action: "Allow"

to:

- namespaces: {} # Use the empty selector with caution because it also selects OpenShift namespaces as well.

- name: "pass-all-egress-to-internet"

action: "Pass"

to:

- networks:

- 0.0.0.0/0

---

apiVersion: policy.networking.k8s.io/v1alpha1

kind: BaselineAdminNetworkPolicy

metadata:

name: default

spec:

subject:

namespaces: {} # Use the empty selector with caution because it also selects OpenShift namespaces as well.

egress:

- name: "deny-all-egress-to-internet"

action: "Deny"

to:

- networks:

- 0.0.0.0/0

---

network-as-egress-peer ANP と、networks ピアを使用する default の BANP を組み合わせると、次の Egress ポリシーが適用されます。

- すべての Pod が、リストされた IP アドレスの外部 DNS サーバーと通信できない。

- すべての Pod が、会社のイントラネットの残りの部分と通信できる。

- すべての Pod が、他の Pod、ノード、およびサービスと通信できる。

-

どの Pod もインターネットと通信できない。最後の ANP

Passルールと強力な BANPDenyルールを組み合わせることで、クラスター内のトラフィックを保護するガードレールポリシーが作成されます。

2.4.1.3. ノードピアとネットワークピアを一緒に使用する

クラスター管理者は、ANP および BANP ポリシーで nodes と networks ピアを組み合わせることができます。

例2.10 nodes と networks ピアの例

apiVersion: policy.networking.k8s.io/v1alpha1

kind: AdminNetworkPolicy

metadata:

name: egress-peer-1

spec:

egress:

- action: "Allow"

name: "allow-egress"

to:

- nodes:

matchExpressions:

- key: worker-group

operator: In

values:

- workloads # Egress traffic from nodes with label worker-group: workloads is allowed.

- networks:

- 104.154.164.170/32

- pods:

namespaceSelector:

matchLabels:

apps: external-apps

podSelector:

matchLabels:

app: web # This rule in the policy allows the traffic directed to pods labeled apps: web in projects with apps: external-apps to leave the cluster.

- action: "Deny"

name: "deny-egress"

to:

- nodes:

matchExpressions:

- key: worker-group

operator: In

values:

- infra # Egress traffic from nodes with label worker-group: infra is denied.

- networks:

- 104.154.164.160/32 # Egress traffic to this IP address from cluster is denied.

- pods:

namespaceSelector:

matchLabels:

apps: internal-apps

podSelector: {}

- action: "Pass"

name: "pass-egress"

to:

- nodes:

matchExpressions:

- key: node-role.kubernetes.io/worker

operator: Exists # All other egress traffic is passed to NetworkPolicy or BANP for evaluation.

priority: 30

subject:

namespaces:

matchLabels:

apps: all-apps- 1

- ポリシーの名前を指定します。

- 2

nodesおよびnetworksピアの場合、egressとして ANP のノースバウンドトラフィック制御のみを使用できます。- 3

- ANP の優先順位を指定して、評価する順序を決定します。優先度の低いルールの方が優先順位が高くなります。ANP は 0 - 99 の値を受け入れます。0 が最高の優先度、99 が最低の優先度です。

- 4

- ポリシーのルールを適用するクラスター内の Pod のセットを指定します。この例では、すべての namespace における、

apps: all-appsラベルを持つすべての Pod がポリシーのsubjectになります。

2.5. AdminNetworkPolicy のトラブルシューティング

2.5.1. ANP の作成の確認

AdminNetworkPolicy (ANP) と BaselineAdminNetworkPolicy (BANP) が正しく作成されていることを確認するには、oc describe anp または oc describe banp のコマンドのステータス出力を確認します。

ステータスが良好な場合は、OVN DB plumbing was successful および SetupSucceeded と表示されます。

例2.11 正常なステータスの ANP の例

...

Conditions:

Last Transition Time: 2024-06-08T20:29:00Z

Message: Setting up OVN DB plumbing was successful

Reason: SetupSucceeded

Status: True

Type: Ready-In-Zone-ovn-control-plane Last Transition Time: 2024-06-08T20:29:00Z

Message: Setting up OVN DB plumbing was successful

Reason: SetupSucceeded

Status: True

Type: Ready-In-Zone-ovn-worker

Last Transition Time: 2024-06-08T20:29:00Z

Message: Setting up OVN DB plumbing was successful

Reason: SetupSucceeded

Status: True

Type: Ready-In-Zone-ovn-worker2

...設定が失敗した場合、それぞれのゾーンコントローラーからエラーが報告されます。

例2.12 不正なステータスとエラーメッセージを含む ANP の例

...

Status:

Conditions:

Last Transition Time: 2024-06-25T12:47:44Z

Message: error attempting to add ANP cluster-control with priority 600 because, OVNK only supports priority ranges 0-99

Reason: SetupFailed

Status: False

Type: Ready-In-Zone-example-worker-1.example.example-org.net

Last Transition Time: 2024-06-25T12:47:45Z

Message: error attempting to add ANP cluster-control with priority 600 because, OVNK only supports priority ranges 0-99

Reason: SetupFailed

Status: False

Type: Ready-In-Zone-example-worker-0.example.example-org.net

Last Transition Time: 2024-06-25T12:47:44Z

Message: error attempting to add ANP cluster-control with priority 600 because, OVNK only supports priority ranges 0-99

Reason: SetupFailed

Status: False

Type: Ready-In-Zone-example-ctlplane-1.example.example-org.net

Last Transition Time: 2024-06-25T12:47:44Z

Message: error attempting to add ANP cluster-control with priority 600 because, OVNK only supports priority ranges 0-99

Reason: SetupFailed

Status: False

Type: Ready-In-Zone-example-ctlplane-2.example.example-org.net

Last Transition Time: 2024-06-25T12:47:44Z

Message: error attempting to add ANP cluster-control with priority 600 because, OVNK only supports priority ranges 0-99

Reason: SetupFailed

Status: False

Type: Ready-In-Zone-example-ctlplane-0.example.example-org.net

```

失敗したポリシーのトラブルシューティングに役立つ nbctl コマンドは、次のセクションを参照してください。

2.5.1.1. ANP および BANP への nbctl コマンドの使用

失敗したセットアップのトラブルシューティングを行うには、まず ACL、AdressSet、Port_Group などの OVN Northbound データベース (nbdb) オブジェクトを確認します。nbdb を表示するには、そのノードの Pod 内にいて、そのノードのデータベース内のオブジェクトを表示する必要があります。

前提条件

-

cluster-adminロールを持つユーザーとしてクラスターにアクセスできる。 -

OpenShift CLI (

oc) がインストールされている。

クラスターで ovn nbctl コマンドを実行するには、関連するノード上の `nbdb` にリモートシェルを起動する必要があります。

出力を生成するために次のポリシーが使用されました。

例2.13 出力の生成に使用される AdminNetworkPolicy

apiVersion: policy.networking.k8s.io/v1alpha1

kind: AdminNetworkPolicy

metadata:

name: cluster-control

spec:

priority: 34

subject:

namespaces:

matchLabels:

anp: cluster-control-anp # Only namespaces with this label have this ANP

ingress:

- name: "allow-from-ingress-router" # rule0

action: "Allow"

from:

- namespaces:

matchLabels:

policy-group.network.openshift.io/ingress: ""

- name: "allow-from-monitoring" # rule1

action: "Allow"

from:

- namespaces:

matchLabels:

kubernetes.io/metadata.name: openshift-monitoring

ports:

- portNumber:

protocol: TCP

port: 7564

- namedPort: "scrape"

- name: "allow-from-open-tenants" # rule2

action: "Allow"

from:

- namespaces: # open tenants

matchLabels:

tenant: open

- name: "pass-from-restricted-tenants" # rule3

action: "Pass"

from:

- namespaces: # restricted tenants

matchLabels:

tenant: restricted

- name: "default-deny" # rule4

action: "Deny"

from:

- namespaces: {} # Use the empty selector with caution because it also selects OpenShift namespaces as well.

egress:

- name: "allow-to-dns" # rule0

action: "Allow"

to:

- pods:

namespaceSelector:

matchLabels:

kubernetes.io/metadata.name: openshift-dns

podSelector:

matchLabels:

app: dns

ports:

- portNumber:

protocol: UDP

port: 5353

- name: "allow-to-kapi-server" # rule1

action: "Allow"

to:

- nodes:

matchExpressions:

- key: node-role.kubernetes.io/control-plane

operator: Exists

ports:

- portNumber:

protocol: TCP

port: 6443

- name: "allow-to-splunk" # rule2

action: "Allow"

to:

- namespaces:

matchLabels:

tenant: splunk

ports:

- portNumber:

protocol: TCP

port: 8991

- portNumber:

protocol: TCP

port: 8992

- name: "allow-to-open-tenants-and-intranet-and-worker-nodes" # rule3

action: "Allow"

to:

- nodes: # worker-nodes

matchExpressions:

- key: node-role.kubernetes.io/worker

operator: Exists

- networks: # intranet

- 172.29.0.0/30

- 10.0.54.0/19

- 10.0.56.38/32

- 10.0.69.0/24

- namespaces: # open tenants

matchLabels:

tenant: open

- name: "pass-to-restricted-tenants" # rule4

action: "Pass"

to:

- namespaces: # restricted tenants

matchLabels:

tenant: restricted

- name: "default-deny"

action: "Deny"

to:

- networks:

- 0.0.0.0/0手順

次のコマンドを実行して、ノード情報を含む Pod をリスト表示します。

$ oc get pods -n openshift-ovn-kubernetes -owide出力例

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES ovnkube-control-plane-5c95487779-8k9fd 2/2 Running 0 34m 10.0.0.5 ci-ln-0tv5gg2-72292-6sjw5-master-0 <none> <none> ovnkube-control-plane-5c95487779-v2xn8 2/2 Running 0 34m 10.0.0.3 ci-ln-0tv5gg2-72292-6sjw5-master-1 <none> <none> ovnkube-node-524dt 8/8 Running 0 33m 10.0.0.4 ci-ln-0tv5gg2-72292-6sjw5-master-2 <none> <none> ovnkube-node-gbwr9 8/8 Running 0 24m 10.0.128.4 ci-ln-0tv5gg2-72292-6sjw5-worker-c-s9gqt <none> <none> ovnkube-node-h4fpx 8/8 Running 0 33m 10.0.0.5 ci-ln-0tv5gg2-72292-6sjw5-master-0 <none> <none> ovnkube-node-j4hzw 8/8 Running 0 24m 10.0.128.2 ci-ln-0tv5gg2-72292-6sjw5-worker-a-hzbh5 <none> <none> ovnkube-node-wdhgv 8/8 Running 0 33m 10.0.0.3 ci-ln-0tv5gg2-72292-6sjw5-master-1 <none> <none> ovnkube-node-wfncn 8/8 Running 0 24m 10.0.128.3 ci-ln-0tv5gg2-72292-6sjw5-worker-b-5bb7f <none> <none>次のコマンドを実行して、Pod に移動してノースバウンドデータベースを確認します。

$ oc rsh -c nbdb -n openshift-ovn-kubernetes ovnkube-node-524dtACL nbdb を確認するには、次のコマンドを実行します。

$ ovn-nbctl find ACL 'external_ids{>=}{"k8s.ovn.org/owner-type"=AdminNetworkPolicy,"k8s.ovn.org/name"=cluster-control}'- 詳細は以下のようになります。, cluster-control

-

トラブルシューティングする

AdminNetworkPolicyの名前を指定します。 - AdminNetworkPolicy

-

AdminNetworkPolicyまたはBaselineAdminNetworkPolicyのタイプを指定します。

例2.14 ACL の出力例

_uuid : 0d5e4722-b608-4bb1-b625-23c323cc9926 action : allow-related direction : to-lport external_ids : {direction=Ingress, gress-index="2", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Ingress:2:None", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=None} label : 0 log : false match : "outport == @a14645450421485494999 && ((ip4.src == $a13730899355151937870))" meter : acl-logging name : "ANP:cluster-control:Ingress:2" options : {} priority : 26598 severity : [] tier : 1 _uuid : b7be6472-df67-439c-8c9c-f55929f0a6e0 action : drop direction : from-lport external_ids : {direction=Egress, gress-index="5", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:5:None", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=None} label : 0 log : false match : "inport == @a14645450421485494999 && ((ip4.dst == $a11452480169090787059))" meter : acl-logging name : "ANP:cluster-control:Egress:5" options : {apply-after-lb="true"} priority : 26595 severity : [] tier : 1 _uuid : 5a6e5bb4-36eb-4209-b8bc-c611983d4624 action : pass direction : to-lport external_ids : {direction=Ingress, gress-index="3", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Ingress:3:None", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=None} label : 0 log : false match : "outport == @a14645450421485494999 && ((ip4.src == $a764182844364804195))" meter : acl-logging name : "ANP:cluster-control:Ingress:3" options : {} priority : 26597 severity : [] tier : 1 _uuid : 04f20275-c410-405c-a923-0e677f767889 action : pass direction : from-lport external_ids : {direction=Egress, gress-index="4", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:4:None", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=None} label : 0 log : false match : "inport == @a14645450421485494999 && ((ip4.dst == $a5972452606168369118))" meter : acl-logging name : "ANP:cluster-control:Egress:4" options : {apply-after-lb="true"} priority : 26596 severity : [] tier : 1 _uuid : 4b5d836a-e0a3-4088-825e-f9f0ca58e538 action : drop direction : to-lport external_ids : {direction=Ingress, gress-index="4", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Ingress:4:None", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=None} label : 0 log : false match : "outport == @a14645450421485494999 && ((ip4.src == $a13814616246365836720))" meter : acl-logging name : "ANP:cluster-control:Ingress:4" options : {} priority : 26596 severity : [] tier : 1 _uuid : 5d09957d-d2cc-4f5a-9ddd-b97d9d772023 action : allow-related direction : from-lport external_ids : {direction=Egress, gress-index="2", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:2:tcp", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=tcp} label : 0 log : false match : "inport == @a14645450421485494999 && ((ip4.dst == $a18396736153283155648)) && tcp && tcp.dst=={8991,8992}" meter : acl-logging name : "ANP:cluster-control:Egress:2" options : {apply-after-lb="true"} priority : 26598 severity : [] tier : 1 _uuid : 1a68a5ed-e7f9-47d0-b55c-89184d97e81a action : allow-related direction : from-lport external_ids : {direction=Egress, gress-index="1", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:1:tcp", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=tcp} label : 0 log : false match : "inport == @a14645450421485494999 && ((ip4.dst == $a10706246167277696183)) && tcp && tcp.dst==6443" meter : acl-logging name : "ANP:cluster-control:Egress:1" options : {apply-after-lb="true"} priority : 26599 severity : [] tier : 1 _uuid : aa1a224d-7960-4952-bdfb-35246bafbac8 action : allow-related direction : to-lport external_ids : {direction=Ingress, gress-index="1", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Ingress:1:tcp", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=tcp} label : 0 log : false match : "outport == @a14645450421485494999 && ((ip4.src == $a6786643370959569281)) && tcp && tcp.dst==7564" meter : acl-logging name : "ANP:cluster-control:Ingress:1" options : {} priority : 26599 severity : [] tier : 1 _uuid : 1a27d30e-3f96-4915-8ddd-ade7f22c117b action : allow-related direction : from-lport external_ids : {direction=Egress, gress-index="3", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:3:None", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=None} label : 0 log : false match : "inport == @a14645450421485494999 && ((ip4.dst == $a10622494091691694581))" meter : acl-logging name : "ANP:cluster-control:Egress:3" options : {apply-after-lb="true"} priority : 26597 severity : [] tier : 1 _uuid : b23a087f-08f8-4225-8c27-4a9a9ee0c407 action : allow-related direction : from-lport external_ids : {direction=Egress, gress-index="0", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:0:udp", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=udp} label : 0 log : false match : "inport == @a14645450421485494999 && ((ip4.dst == $a13517855690389298082)) && udp && udp.dst==5353" meter : acl-logging name : "ANP:cluster-control:Egress:0" options : {apply-after-lb="true"} priority : 26600 severity : [] tier : 1 _uuid : d14ed5cf-2e06-496e-8cae-6b76d5dd5ccd action : allow-related direction : to-lport external_ids : {direction=Ingress, gress-index="0", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Ingress:0:None", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=None} label : 0 log : false match : "outport == @a14645450421485494999 && ((ip4.src == $a14545668191619617708))" meter : acl-logging name : "ANP:cluster-control:Ingress:0" options : {} priority : 26600 severity : [] tier : 1注記Ingress および Egress の出力には、ACL のポリシーのロジックが表示されます。たとえば、パケットが指定された

matchと一致するたびにactionが実行されます。次のコマンドを実行して、ルールの特定の ACL を調べます。

$ ovn-nbctl find ACL 'external_ids{>=}{"k8s.ovn.org/owner-type"=AdminNetworkPolicy,direction=Ingress,"k8s.ovn.org/name"=cluster-control,gress-index="1"}'- 詳細は以下のようになります。,

cluster-control -

ANP の

nameを指定します。 Ingress-

トラフィックの

directionをIngressまたはEgressのいずれかのタイプで指定します。 1- 確認するルールを指定します。

priority34のcluster-controlという名前の ANP の例では、Ingressrule1 の出力例は次のとおりです。例2.15 出力例

_uuid : aa1a224d-7960-4952-bdfb-35246bafbac8 action : allow-related direction : to-lport external_ids : {direction=Ingress, gress-index="1", "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Ingress:1:tcp", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy, port-policy-protocol=tcp} label : 0 log : false match : "outport == @a14645450421485494999 && ((ip4.src == $a6786643370959569281)) && tcp && tcp.dst==7564" meter : acl-logging name : "ANP:cluster-control:Ingress:1" options : {} priority : 26599 severity : [] tier : 1- 詳細は以下のようになります。,

nbdb 内のアドレスセットを確認するには、次のコマンドを実行します。

$ ovn-nbctl find Address_Set 'external_ids{>=}{"k8s.ovn.org/owner-type"=AdminNetworkPolicy,"k8s.ovn.org/name"=cluster-control}'例2.16

Address_Setの出力例_uuid : 56e89601-5552-4238-9fc3-8833f5494869 addresses : ["192.168.194.135", "192.168.194.152", "192.168.194.193", "192.168.194.254"] external_ids : {direction=Egress, gress-index="1", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:1:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a10706246167277696183 _uuid : 7df9330d-380b-4bdb-8acd-4eddeda2419c addresses : ["10.132.0.10", "10.132.0.11", "10.132.0.12", "10.132.0.13", "10.132.0.14", "10.132.0.15", "10.132.0.16", "10.132.0.17", "10.132.0.5", "10.132.0.7", "10.132.0.71", "10.132.0.75", "10.132.0.8", "10.132.0.81", "10.132.0.9", "10.132.2.10", "10.132.2.11", "10.132.2.12", "10.132.2.14", "10.132.2.15", "10.132.2.3", "10.132.2.4", "10.132.2.5", "10.132.2.6", "10.132.2.7", "10.132.2.8", "10.132.2.9", "10.132.3.64", "10.132.3.65", "10.132.3.72", "10.132.3.73", "10.132.3.76", "10.133.0.10", "10.133.0.11", "10.133.0.12", "10.133.0.13", "10.133.0.14", "10.133.0.15", "10.133.0.16", "10.133.0.17", "10.133.0.18", "10.133.0.19", "10.133.0.20", "10.133.0.21", "10.133.0.22", "10.133.0.23", "10.133.0.24", "10.133.0.25", "10.133.0.26", "10.133.0.27", "10.133.0.28", "10.133.0.29", "10.133.0.30", "10.133.0.31", "10.133.0.32", "10.133.0.33", "10.133.0.34", "10.133.0.35", "10.133.0.36", "10.133.0.37", "10.133.0.38", "10.133.0.39", "10.133.0.40", "10.133.0.41", "10.133.0.42", "10.133.0.44", "10.133.0.45", "10.133.0.46", "10.133.0.47", "10.133.0.48", "10.133.0.5", "10.133.0.6", "10.133.0.7", "10.133.0.8", "10.133.0.9", "10.134.0.10", "10.134.0.11", "10.134.0.12", "10.134.0.13", "10.134.0.14", "10.134.0.15", "10.134.0.16", "10.134.0.17", "10.134.0.18", "10.134.0.19", "10.134.0.20", "10.134.0.21", "10.134.0.22", "10.134.0.23", "10.134.0.24", "10.134.0.25", "10.134.0.26", "10.134.0.27", "10.134.0.28", "10.134.0.30", "10.134.0.31", "10.134.0.32", "10.134.0.33", "10.134.0.34", "10.134.0.35", "10.134.0.36", "10.134.0.37", "10.134.0.38", "10.134.0.4", "10.134.0.42", "10.134.0.9", "10.135.0.10", "10.135.0.11", "10.135.0.12", "10.135.0.13", "10.135.0.14", "10.135.0.15", "10.135.0.16", "10.135.0.17", "10.135.0.18", "10.135.0.19", "10.135.0.23", "10.135.0.24", "10.135.0.26", "10.135.0.27", "10.135.0.29", "10.135.0.3", "10.135.0.4", "10.135.0.40", "10.135.0.41", "10.135.0.42", "10.135.0.43", "10.135.0.44", "10.135.0.5", "10.135.0.6", "10.135.0.7", "10.135.0.8", "10.135.0.9"] external_ids : {direction=Ingress, gress-index="4", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Ingress:4:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a13814616246365836720 _uuid : 84d76f13-ad95-4c00-8329-a0b1d023c289 addresses : ["10.132.3.76", "10.135.0.44"] external_ids : {direction=Egress, gress-index="4", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:4:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a5972452606168369118 _uuid : 0c53e917-f7ee-4256-8f3a-9522c0481e52 addresses : ["10.132.0.10", "10.132.0.11", "10.132.0.12", "10.132.0.13", "10.132.0.14", "10.132.0.15", "10.132.0.16", "10.132.0.17", "10.132.0.5", "10.132.0.7", "10.132.0.71", "10.132.0.75", "10.132.0.8", "10.132.0.81", "10.132.0.9", "10.132.2.10", "10.132.2.11", "10.132.2.12", "10.132.2.14", "10.132.2.15", "10.132.2.3", "10.132.2.4", "10.132.2.5", "10.132.2.6", "10.132.2.7", "10.132.2.8", "10.132.2.9", "10.132.3.64", "10.132.3.65", "10.132.3.72", "10.132.3.73", "10.132.3.76", "10.133.0.10", "10.133.0.11", "10.133.0.12", "10.133.0.13", "10.133.0.14", "10.133.0.15", "10.133.0.16", "10.133.0.17", "10.133.0.18", "10.133.0.19", "10.133.0.20", "10.133.0.21", "10.133.0.22", "10.133.0.23", "10.133.0.24", "10.133.0.25", "10.133.0.26", "10.133.0.27", "10.133.0.28", "10.133.0.29", "10.133.0.30", "10.133.0.31", "10.133.0.32", "10.133.0.33", "10.133.0.34", "10.133.0.35", "10.133.0.36", "10.133.0.37", "10.133.0.38", "10.133.0.39", "10.133.0.40", "10.133.0.41", "10.133.0.42", "10.133.0.44", "10.133.0.45", "10.133.0.46", "10.133.0.47", "10.133.0.48", "10.133.0.5", "10.133.0.6", "10.133.0.7", "10.133.0.8", "10.133.0.9", "10.134.0.10", "10.134.0.11", "10.134.0.12", "10.134.0.13", "10.134.0.14", "10.134.0.15", "10.134.0.16", "10.134.0.17", "10.134.0.18", "10.134.0.19", "10.134.0.20", "10.134.0.21", "10.134.0.22", "10.134.0.23", "10.134.0.24", "10.134.0.25", "10.134.0.26", "10.134.0.27", "10.134.0.28", "10.134.0.30", "10.134.0.31", "10.134.0.32", "10.134.0.33", "10.134.0.34", "10.134.0.35", "10.134.0.36", "10.134.0.37", "10.134.0.38", "10.134.0.4", "10.134.0.42", "10.134.0.9", "10.135.0.10", "10.135.0.11", "10.135.0.12", "10.135.0.13", "10.135.0.14", "10.135.0.15", "10.135.0.16", "10.135.0.17", "10.135.0.18", "10.135.0.19", "10.135.0.23", "10.135.0.24", "10.135.0.26", "10.135.0.27", "10.135.0.29", "10.135.0.3", "10.135.0.4", "10.135.0.40", "10.135.0.41", "10.135.0.42", "10.135.0.43", "10.135.0.44", "10.135.0.5", "10.135.0.6", "10.135.0.7", "10.135.0.8", "10.135.0.9"] external_ids : {direction=Egress, gress-index="2", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:2:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a18396736153283155648 _uuid : 5228bf1b-dfd8-40ec-bfa8-95c5bf9aded9 addresses : [] external_ids : {direction=Ingress, gress-index="0", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Ingress:0:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a14545668191619617708 _uuid : 46530d69-70da-4558-8c63-884ec9dc4f25 addresses : ["10.132.2.10", "10.132.2.5", "10.132.2.6", "10.132.2.7", "10.132.2.8", "10.132.2.9", "10.133.0.47", "10.134.0.33", "10.135.0.10", "10.135.0.11", "10.135.0.12", "10.135.0.19", "10.135.0.24", "10.135.0.7", "10.135.0.8", "10.135.0.9"] external_ids : {direction=Ingress, gress-index="1", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Ingress:1:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a6786643370959569281 _uuid : 65fdcdea-0b9f-4318-9884-1b51d231ad1d addresses : ["10.132.3.72", "10.135.0.42"] external_ids : {direction=Ingress, gress-index="2", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Ingress:2:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a13730899355151937870 _uuid : 73eabdb0-36bf-4ca3-b66d-156ac710df4c addresses : ["10.0.32.0/19", "10.0.56.38/32", "10.0.69.0/24", "10.132.3.72", "10.135.0.42", "172.29.0.0/30", "192.168.194.103", "192.168.194.2"] external_ids : {direction=Egress, gress-index="3", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:3:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a10622494091691694581 _uuid : 50cdbef2-71b5-474b-914c-6fcd1d7712d3 addresses : ["10.132.0.10", "10.132.0.11", "10.132.0.12", "10.132.0.13", "10.132.0.14", "10.132.0.15", "10.132.0.16", "10.132.0.17", "10.132.0.5", "10.132.0.7", "10.132.0.71", "10.132.0.75", "10.132.0.8", "10.132.0.81", "10.132.0.9", "10.132.2.10", "10.132.2.11", "10.132.2.12", "10.132.2.14", "10.132.2.15", "10.132.2.3", "10.132.2.4", "10.132.2.5", "10.132.2.6", "10.132.2.7", "10.132.2.8", "10.132.2.9", "10.132.3.64", "10.132.3.65", "10.132.3.72", "10.132.3.73", "10.132.3.76", "10.133.0.10", "10.133.0.11", "10.133.0.12", "10.133.0.13", "10.133.0.14", "10.133.0.15", "10.133.0.16", "10.133.0.17", "10.133.0.18", "10.133.0.19", "10.133.0.20", "10.133.0.21", "10.133.0.22", "10.133.0.23", "10.133.0.24", "10.133.0.25", "10.133.0.26", "10.133.0.27", "10.133.0.28", "10.133.0.29", "10.133.0.30", "10.133.0.31", "10.133.0.32", "10.133.0.33", "10.133.0.34", "10.133.0.35", "10.133.0.36", "10.133.0.37", "10.133.0.38", "10.133.0.39", "10.133.0.40", "10.133.0.41", "10.133.0.42", "10.133.0.44", "10.133.0.45", "10.133.0.46", "10.133.0.47", "10.133.0.48", "10.133.0.5", "10.133.0.6", "10.133.0.7", "10.133.0.8", "10.133.0.9", "10.134.0.10", "10.134.0.11", "10.134.0.12", "10.134.0.13", "10.134.0.14", "10.134.0.15", "10.134.0.16", "10.134.0.17", "10.134.0.18", "10.134.0.19", "10.134.0.20", "10.134.0.21", "10.134.0.22", "10.134.0.23", "10.134.0.24", "10.134.0.25", "10.134.0.26", "10.134.0.27", "10.134.0.28", "10.134.0.30", "10.134.0.31", "10.134.0.32", "10.134.0.33", "10.134.0.34", "10.134.0.35", "10.134.0.36", "10.134.0.37", "10.134.0.38", "10.134.0.4", "10.134.0.42", "10.134.0.9", "10.135.0.10", "10.135.0.11", "10.135.0.12", "10.135.0.13", "10.135.0.14", "10.135.0.15", "10.135.0.16", "10.135.0.17", "10.135.0.18", "10.135.0.19", "10.135.0.23", "10.135.0.24", "10.135.0.26", "10.135.0.27", "10.135.0.29", "10.135.0.3", "10.135.0.4", "10.135.0.40", "10.135.0.41", "10.135.0.42", "10.135.0.43", "10.135.0.44", "10.135.0.5", "10.135.0.6", "10.135.0.7", "10.135.0.8", "10.135.0.9"] external_ids : {direction=Egress, gress-index="0", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:0:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a13517855690389298082 _uuid : 32a42f32-2d11-43dd-979d-a56d7ee6aa57 addresses : ["10.132.3.76", "10.135.0.44"] external_ids : {direction=Ingress, gress-index="3", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Ingress:3:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a764182844364804195 _uuid : 8fd3b977-6e1c-47aa-82b7-e3e3136c4a72 addresses : ["0.0.0.0/0"] external_ids : {direction=Egress, gress-index="5", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:5:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a11452480169090787059次のコマンドを実行して、ルールの特定のアドレスセットを調べます。

$ ovn-nbctl find Address_Set 'external_ids{>=}{"k8s.ovn.org/owner-type"=AdminNetworkPolicy,direction=Egress,"k8s.ovn.org/name"=cluster-control,gress-index="5"}'例2.17

Address_Setの出力例_uuid : 8fd3b977-6e1c-47aa-82b7-e3e3136c4a72 addresses : ["0.0.0.0/0"] external_ids : {direction=Egress, gress-index="5", ip-family=v4, "k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control:Egress:5:v4", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a11452480169090787059

次のコマンドを実行して、nbdb 内のポートグループを確認します。

$ ovn-nbctl find Port_Group 'external_ids{>=}{"k8s.ovn.org/owner-type"=AdminNetworkPolicy,"k8s.ovn.org/name"=cluster-control}'例2.18

Port_Groupの出力例_uuid : f50acf71-7488-4b9a-b7b8-c8a024e99d21 acls : [04f20275-c410-405c-a923-0e677f767889, 0d5e4722-b608-4bb1-b625-23c323cc9926, 1a27d30e-3f96-4915-8ddd-ade7f22c117b, 1a68a5ed-e7f9-47d0-b55c-89184d97e81a, 4b5d836a-e0a3-4088-825e-f9f0ca58e538, 5a6e5bb4-36eb-4209-b8bc-c611983d4624, 5d09957d-d2cc-4f5a-9ddd-b97d9d772023, aa1a224d-7960-4952-bdfb-35246bafbac8, b23a087f-08f8-4225-8c27-4a9a9ee0c407, b7be6472-df67-439c-8c9c-f55929f0a6e0, d14ed5cf-2e06-496e-8cae-6b76d5dd5ccd] external_ids : {"k8s.ovn.org/id"="default-network-controller:AdminNetworkPolicy:cluster-control", "k8s.ovn.org/name"=cluster-control, "k8s.ovn.org/owner-controller"=default-network-controller, "k8s.ovn.org/owner-type"=AdminNetworkPolicy} name : a14645450421485494999 ports : [5e75f289-8273-4f8a-8798-8c10f7318833, de7e1b71-6184-445d-93e7-b20acadf41ea]

2.6. AdminNetworkPolicy のベストプラクティス

このセクションでは、AdminNetworkPolicy および BaselineAdminNetworkPolicy リソースのベストプラクティスを説明します。

2.6.1. AdminNetworkPolicy の設計

AdminNetworkPolicy (ANP) リソースを構築する場合は、ポリシーを作成するときに次の点を考慮する必要があります。

- 同じ優先度を持つ ANP を作成できます。同じ優先度で 2 つの ANP を作成する場合は、重複するルールが同じトラフィックに適用されないようにしてください。値ごとに 1 つのルールのみが適用されます。同じ優先度の値が複数ある場合は、どのルールが適用されるか保証されません。重複する ANP を作成すると、どのポリシーが優先されるか保証されません。そのため、優先順位が明確に定義されるように、異なる優先度で ANP を設定してください。

- 管理者は、システム namespace ではなくユーザー namespace に適用される ANP を作成する必要があります。

ANP および BaselineAdminNetworkPolicy (BANP) をシステム namespace (default、kube-system、名前が openshift- で始まる namespace など) に適用することはサポートされていないため、クラスターが応答しなくなり、機能しない状態になる可能性があります。

-

サポートされている優先度の範囲は

0-100であるため、30-70のような中間の範囲を使用するように ANP を設計することもできます。これにより、前後の優先順位のためのプレースホルダーが残ります。中間の範囲でも、インフラストラクチャーの要件が時間の経過とともに進化するにつれて、適切な優先度レベルで必要なときに新しい ANP を挿入できるように、ギャップを残しておくことを推奨します。ANP をパックすると、将来の変更に対応するために、それらをすべて再作成しないといけない場合があります。 -

0.0.0.0/0または::/0を使用して強力なDenyポリシーを作成する場合は、重要なトラフィックに対して優先度の高いAllowまたはPassルールがあることを確認してください。 -

どのような場合でも接続が許可されるようにしたい場合は、

actionフィールドとしてAllowを使用します。ANP のAllowルールは、接続が常に許可され、NetworkPolicyが無視されることを意味します。 -

接続を許可または拒否するポリシー決定を

NetworkPolicyレイヤーに委任するには、actionフィールドにPassを使用します。 - 複数のルールにわたるセレクターが重複しないようにして、同じ IP が複数のポリシーに表示されないようにします。これにより、パフォーマンスとスケールの制限が発生する可能性があります。

-

namedPortsをPortNumberおよびPortRangeと組み合わせて使用することは避けてください。これにより 6 つの ACL が作成され、クラスターの効率が低下します。

2.6.1.1. BaselineAdminNetworkPolicy の使用に関する考慮事項

クラスター内で定義できる

BaselineAdminNetworkPolicy(BANP) リソースは 1 つだけです。以下は、管理者が BANP を設計する際に考慮する可能性がある、BANP でサポートされている用途です。-

ユーザー namespace 内のクラスターローカル Ingress に対してデフォルトの拒否ポリシーを設定できます。この BANP により、開発者は許可したい Ingress トラフィックを許可するために

NetworkPolicyオブジェクトを追加する必要があり、Ingress 用のネットワークポリシーを追加しないとトラフィックが拒否されます。 -

ユーザー namespace のクラスターローカル Egress に対してデフォルトの拒否ポリシーを設定できます。この BANP により、開発者は許可する Egress トラフィックを許可するために

NetworkPolicyオブジェクトを追加する必要があり、ネットワークポリシーを追加しないとトラフィックが拒否されます。 -

クラスター内 DNS サービスへの Egress に対してデフォルトの許可ポリシーを設定できます。このような BANP により、namespace のユーザーは、クラスター内 DNS サービスへの許可 Egress

NetworkPolicyを設定する必要がなくなります。 -

すべての Pod への内部 Egress トラフィックを許可し、すべての外部エンドポイント (つまり

0.0.0.0/0および::/0) へのアクセスを拒否する Egress ポリシーを設定できます。この BANP により、ユーザーワークロードは他のクラスター内エンドポイントにトラフィックを送信できますが、デフォルトでは外部エンドポイントには送信できません。開発者はNetworkPolicyを使用して、アプリケーションが明示的な外部サービスセットにトラフィックを送信できるようにすることができます。

-

ユーザー namespace 内のクラスターローカル Ingress に対してデフォルトの拒否ポリシーを設定できます。この BANP により、開発者は許可したい Ingress トラフィックを許可するために

-

BANP のスコープを設定し、システム namespace ではなくユーザー namespace へのトラフィックのみを拒否するようにしてください。これは、システム namespace に BANP をオーバーライドする

NetworkPolicyオブジェクトがないためです。

2.6.1.2. AdminNetworkPolicy と NetworkPolicy の考慮すべき相違点

-

NetworkPolicyオブジェクトとは異なり、誤ってトラフィックが選択されることを避けるために、空の ({}) キャッチオールセレクターを使用するのではなく、明示的なラベルを使用して ANP および BANP 内のワークロードを参照する必要があります。

インフラストラクチャー namespace に空の namespace セレクターを適用すると、クラスターが応答しなくなり、機能しない状態になる可能性があります。

-

ANP の API セマンティクスでは、暗黙的な拒否を持つ

NetworkPolicyオブジェクトとは異なり、ポリシーを作成するときに許可または拒否のルールを明示的に定義する必要があります。 -

NetworkPolicyオブジェクトとは異なり、AdminNetworkPolicyオブジェクトの Ingress ルールはクラスター内の Pod と namespace に制限されているため、ホストネットワークからの Ingress のルールを設定することはできず、また設定する必要もありません。

第3章 ネットワークポリシー

3.1. ネットワークポリシーについて

開発者は、クラスター内の Pod へのトラフィックを制限するネットワークポリシーを定義できます。

3.1.1. ネットワークポリシーについて

デフォルトで、プロジェクトのすべての Pod は他の Pod およびネットワークのエンドポイントからアクセスできます。プロジェクトで 1 つ以上の Pod を分離するには、そのプロジェクトで NetworkPolicy オブジェクトを作成し、許可する着信接続を指定します。プロジェクト管理者は独自のプロジェクト内で NetworkPolicy オブジェクトの作成および削除を実行できます。

Pod が 1 つ以上の NetworkPolicy オブジェクトのセレクターで一致する場合、Pod はそれらの 1 つ以上の NetworkPolicy オブジェクトで許可される接続のみを受け入れます。NetworkPolicy オブジェクトによって選択されていない Pod は完全にアクセス可能です。

ネットワークポリシーは、Transmission Control Protocol (TCP)、User Datagram Protocol (UDP)、Internet Control Message Protocol (ICMP)、および Stream Control Transmission Protocol (SCTP) プロトコルにのみ適用されます。他のプロトコルは影響を受けません。

- ネットワークポリシーは、ホストのネットワーク namespace には適用されません。ホストネットワークが有効にされている Pod はネットワークポリシールールによる影響を受けません。ただし、ホストネットワークを使用する Pod に接続する Pod は、ネットワークポリシールールの影響を受ける可能性があります。

-

podSelectorフィールドを{}に設定せずにnamespaceSelectorフィールドを使用すると、hostNetworkPod が含まれません。ネットワークポリシーの作成時にhostNetworkPod をターゲットにするには、namespaceSelectorフィールドでpodSelectorを{}に設定して使用する必要があります。 - ネットワークポリシーは、ローカルホストまたは常駐ノードからのトラフィックをブロックすることはできません。

ネットワークポリシーを作成する際は、カスタムネームスペースまたはプロジェクトに

network.openshift.io/policy-group: ingressラベルを適用しないでください。このラベルは Operator が管理し、OpenShift Container Platform のネットワーク機能専用です。システムによって作成された名前空間では、これを変更してはいけません。このラベルを使用すると、断続的なネットワーク接続の切断、意図しないシステム

NetworkPoliciesリソースの適用、またはオペレーターが状態を調整しようとする際に設定のずれが発生する可能性があります。カスタムトラフィックグループを作成する場合は、必ず以下の手順に示すように、一意のユーザー定義ラベルを使用してください。

以下のサンプル NetworkPolicy オブジェクトは、複数の異なるシナリオをサポートすることを示しています。

すべてのトラフィックを拒否します。

プロジェクトに deny by default (デフォルトで拒否) を実行させるには、すべての Pod に一致するが、トラフィックを一切許可しない

NetworkPolicyオブジェクトを追加します。kind: NetworkPolicy apiVersion: networking.k8s.io/v1 metadata: name: deny-by-default spec: podSelector: {} ingress: []OpenShift Container Platform Ingress Controller からの接続のみを許可します。

プロジェクトで OpenShift Container Platform Ingress Controller からの接続のみを許可するには、以下の

NetworkPolicyオブジェクトを追加します。apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: allow-from-openshift-ingress spec: ingress: - from: - namespaceSelector: matchLabels: policy-group.network.openshift.io/ingress: "" podSelector: {} policyTypes: - Ingressプロジェクト内の Pod からの接続のみを受け入れます。

重要同じ namespace 内の

hostNetworkPod からの Ingress 接続を許可するには、allow-from-hostnetworkポリシーとallow-same-namespaceポリシーを一緒に適用する必要があります。Pod が同じプロジェクト内の他の Pod からの接続を受け入れるが、他のプロジェクトの Pod からの接続を拒否するように設定するには、以下の

NetworkPolicyオブジェクトを追加します。kind: NetworkPolicy apiVersion: networking.k8s.io/v1 metadata: name: allow-same-namespace spec: podSelector: {} ingress: - from: - podSelector: {}Pod ラベルに基づいて HTTP および HTTPS トラフィックのみを許可します。

特定のラベル (以下の例の

role=frontend) の付いた Pod への HTTP および HTTPS アクセスのみを有効にするには、以下と同様のNetworkPolicyオブジェクトを追加します。kind: NetworkPolicy apiVersion: networking.k8s.io/v1 metadata: name: allow-http-and-https spec: podSelector: matchLabels: role: frontend ingress: - ports: - protocol: TCP port: 80 - protocol: TCP port: 443namespace および Pod セレクターの両方を使用して接続を受け入れます。

namespace と Pod セレクターを組み合わせてネットワークトラフィックのマッチングをするには、以下と同様の

NetworkPolicyオブジェクトを使用できます。kind: NetworkPolicy apiVersion: networking.k8s.io/v1 metadata: name: allow-pod-and-namespace-both spec: podSelector: matchLabels: name: test-pods ingress: - from: - namespaceSelector: matchLabels: project: project_name podSelector: matchLabels: name: test-pods

NetworkPolicy オブジェクトは加算されるものです。つまり、複数の NetworkPolicy オブジェクトを組み合わせて複雑なネットワーク要件を満すことができます。

たとえば、先の例で定義された NetworkPolicy オブジェクトの場合、同じプロジェト内に allow-same-namespace と allow-http-and-https ポリシーの両方を定義することができます。これにより、ラベル role=frontend の付いた Pod は各ポリシーで許可されるすべての接続を受け入れます。つまり、同じ namespace の Pod からのすべてのポート、およびすべての namespace の Pod からのポート 80 および 443 での接続を受け入れます。

3.1.1.1. allow-from-router ネットワークポリシーの使用

次の NetworkPolicy を使用して、ルーターの設定に関係なく外部トラフィックを許可します。

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

name: allow-from-router

spec:

ingress:

- from:

- namespaceSelector:

matchLabels:

policy-group.network.openshift.io/ingress: ""

podSelector: {}

policyTypes:

- Ingress- 1

policy-group.network.openshift.io/ingress:""ラベルは OVN-Kubernetes をサポートします。

3.1.1.2. allow-from-hostnetwork ネットワークポリシーの使用

次の allow-from-hostnetwork NetworkPolicy オブジェクトを追加して、ホストネットワーク Pod からのトラフィックを転送します。

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

name: allow-from-hostnetwork

spec:

ingress:

- from:

- namespaceSelector:

matchLabels:

policy-group.network.openshift.io/host-network: ""

podSelector: {}

policyTypes:

- Ingress3.1.2. OVN-Kubernetes ネットワークプラグインによるネットワークポリシーの最適化

OVN-Kubernetes のネットワークポリシーを最適化してフロー数を削減し、必要な場合に外部 IP トラフィックを許可する方法を学びましょう。

ネットワークポリシーを設計する場合は、以下のガイドラインを参照してください。

-

同じ

spec.podSelector仕様を持つネットワークポリシーの場合、ingressルールまたはegressルールを持つ複数のネットワークポリシーを使用するよりも、複数のingressルールまたはegressルールを持つ 1 つのネットワークポリシーを使用する方が効率的です。 podSelectorまたはnamespaceSelector仕様に基づくすべてのingressまたはegressルールは、number of pods selected by network policy + number of pods selected by ingress or egress ruleに比例する数の OVS フローを生成します。そのため、Pod ごとに個別のルールを作成するのではなく、1 つのルールで必要な数の Pod を選択できるpodSelectorまたはnamespaceSelector仕様を使用することが推奨されます。たとえば、以下のポリシーには 2 つのルールが含まれています。

apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: test-network-policy spec: podSelector: {} ingress: - from: - podSelector: matchLabels: role: frontend - from: - podSelector: matchLabels: role: backend以下のポリシーは、上記と同じ 2 つのルールを 1 つのルールとして表現しています。

apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: test-network-policy spec: podSelector: {} ingress: - from: - podSelector: matchExpressions: - {key: role, operator: In, values: [frontend, backend]}同じガイドラインが

spec.podSelector仕様に適用されます。異なるネットワークポリシーに同じingressルールまたはegressルールがある場合、共通のspec.podSelector仕様で 1 つのネットワークポリシーを作成する方が効率的な場合があります。たとえば、以下の 2 つのポリシーには異なるルールがあります。apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: policy1 spec: podSelector: matchLabels: role: db ingress: - from: - podSelector: matchLabels: role: frontend --- apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: policy2 spec: podSelector: matchLabels: role: client ingress: - from: - podSelector: matchLabels: role: frontend以下のネットワークポリシーは、上記と同じ 2 つのルールを 1 つのルールとして表現しています。

apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: policy3 spec: podSelector: matchExpressions: - {key: role, operator: In, values: [db, client]} ingress: - from: - podSelector: matchLabels: role: frontendこの最適化は、複数のセレクターを 1 つのセレクターとして表現する場合に限り適用できます。セレクターが異なるラベルに基づいている場合、この最適化は適用できない可能性があります。その場合は、ネットワークポリシーの最適化に特化して新規ラベルをいくつか適用することを検討してください。

3.1.2.1. OVN-Kubernetes の NetworkPolicy CR と外部 IP

OVN-Kubernetes では、NetworkPolicy カスタムリソース (CR) によって厳密な分離ルールが適用されます。サービスが外部 IP を使用して公開されている場合、トラフィックを許可するように明示的に設定されていない限り、ネットワークポリシーによって他の namespace からのアクセスがブロックされる可能性があります。

namespace をまたいで外部 IP へのアクセスを許可するには、必要な namespace からの Ingress を明示的に許可し、指定されたサービスポートへのトラフィックが許可されるようにする NetworkPolicy CR を作成します。必要なポートへのトラフィックを許可しなければ、アクセスが制限される可能性があります。

出力例

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

annotations:

name: <policy_name>

namespace: openshift-ingress

spec:

ingress:

- ports:

- port: 80

protocol: TCP

- ports:

- port: 443

protocol: TCP

- from:

- namespaceSelector:

matchLabels:

kubernetes.io/metadata.name: <my_namespace>

podSelector: {}

policyTypes:

- Ingressここでは、以下のようになります。

<policy_name>- ポリシーの名前を指定します。

<my_namespace>- ポリシーがデプロイされる namespace の名前を指定します。

詳細は、「ネットワークポリシーについて」を参照してください。

3.1.3. 次のステップ

3.2. ネットワークポリシーの作成

クラスター管理者は、namespace のネットワークポリシーを作成できます。

3.2.1. NetworkPolicy オブジェクトの例

以下は、NetworkPolicy オブジェクトの設定例に解説を付けたものです。

kind: NetworkPolicy

apiVersion: networking.k8s.io/v1

metadata:

name: allow-27107

spec:

podSelector:

matchLabels:

app: mongodb

ingress:

- from:

- podSelector:

matchLabels:

app: app

ports:

- protocol: TCP

port: 27017ここでは、以下のようになります。

name- NetworkPolicy オブジェクトの名前。

spec.podSelector- ポリシーが適用される Pod を説明するセレクター。ポリシーオブジェクトは NetworkPolicy オブジェクトが定義されるプロジェクトの Pod のみを選択できます。

ingress.from.podSelector- ポリシーオブジェクトが入力トラフィックを許可する Pod に一致するセレクター。セレクターは、NetworkPolicy と同じ namespace にある Pod を照合して検索します。

ingress.ports- トラフィックを受け入れる 1 つ以上の宛先ポートのリスト。

3.2.2. CLI を使用したネットワークポリシーの作成

クラスターの namespace に許可される Ingress または Egress ネットワークトラフィックを記述する詳細なルールを定義するには、ネットワークポリシーを作成できます。

cluster-admin ロールを持つユーザーでログインしている場合、クラスター内の namespace でネットワークポリシーを作成できます。

前提条件

-

クラスターが、

mode: NetworkPolicyが設定されたNetworkPolicyオブジェクトをサポートするネットワークプラグイン (OVN-Kubernetes ネットワークプラグインなど) を使用している。 -

OpenShift CLI (

oc) がインストールされている。 -

あなたは

管理者権限を持つユーザー特権でクラスターにログインしました。 - ネットワークポリシーが適用される namespace で作業している。

手順

ポリシールールを作成します。

<policy_name>.yamlファイルを作成します。$ touch <policy_name>.yamlここでは、以下のようになります。

<policy_name>- ネットワークポリシーファイル名を指定します。

作成したファイルにネットワークポリシーを定義します。次の例では、全 namespace 内の全 Pod からの Ingress トラフィックを拒否します。これは基本的なポリシーであり、他のネットワークポリシーの設定によって許可されたクロス Pod トラフィック以外のすべてのクロス Pod ネットワーキングをブロックします。

kind: NetworkPolicy apiVersion: networking.k8s.io/v1 spec: podSelector: {} policyTypes: - Ingress ingress: []次の設定例では、同じ namespace 内の全 Pod からの Ingress トラフィックを許可します。

kind: NetworkPolicy apiVersion: networking.k8s.io/v1 metadata: name: allow-same-namespace spec: podSelector: ingress: - from: - podSelector: {} # ...次の例では、特定の namespace から 1 つの Pod への Ingress トラフィックを許可します。このポリシーは

、名前空間 yで実行されている Pod から、pod-aラベルを持つ Pod へのトラフィックを許可します。kind: NetworkPolicy apiVersion: networking.k8s.io/v1 metadata: name: allow-traffic-pod spec: podSelector: matchLabels: pod: pod-a policyTypes: - Ingress ingress: - from: - namespaceSelector: matchLabels: kubernetes.io/metadata.name: namespace-y # ...次の設定例では、サービスへのトラフィックを制限します。このポリシーを適用すると、

app=bookstoreとrole=apiの両方のラベルを持つすべての Pod に、app=bookstoreというラベルを持つ Pod のみがアクセスできるようになります。この例では、アプリケーションは、ラベルapp=bookstoreおよびrole=apiでマークされた REST API サーバーである可能性があります。この設定例は、次のユースケースに対応しています。

- サービスへのトラフィックを、それを使用する必要がある他のマイクロサービスのみに制限します。

データベースへの接続を制限して、それを使用するアプリケーションのみを許可します。

kind: NetworkPolicy apiVersion: networking.k8s.io/v1 metadata: name: api-allow spec: podSelector: matchLabels: app: bookstore role: api ingress: - from: - podSelector: matchLabels: app: bookstore # ...

ネットワークポリシーオブジェクトを作成するには、以下のコマンドを入力します。正常に処理された場合、ポリシーオブジェクトの名前と

作成ステータスが表示されます。$ oc apply -f <policy_name>.yaml -n <namespace>ここでは、以下のようになります。

<policy_name>- ネットワークポリシーファイル名を指定します。

<namespace>- オプションのパラメーター。現在の namespace とは異なる namespace でオブジェクトを定義した場合、パラメーターは namespace を指定します。

正常に処理された場合、ポリシーオブジェクトの名前と

作成ステータスが表示されます。注記cluster-admin権限で Web コンソールにログインする場合、YAML で、または Web コンソールのフォームから、クラスターの任意の namespace でネットワークポリシーを直接作成できます。

3.2.3. デフォルトの全拒否ネットワークポリシーの作成

デフォルトの全拒否ネットワークポリシーは、デプロイされた他のネットワークポリシーの設定によって許可されるネットワークトラフィックと、ホストネットワークを使用する Pod 間のトラフィック以外のすべての Pod 間ネットワークをブロックします。この手順では 、my-project 名前空間に デフォルトで拒否する ポリシーを適用することにより、強力な拒否ポリシーを強制します。

トラフィック通信を許可する NetworkPolicy カスタムリソース (CR) を設定しない場合、以下のポリシーはクラスター全体で通信問題を引き起こす可能性があります。

前提条件

-

クラスターが、

mode: NetworkPolicyが設定されたNetworkPolicyオブジェクトをサポートするネットワークプラグイン (OVN-Kubernetes ネットワークプラグインなど) を使用している。 -

OpenShift CLI (

oc) がインストールされている。 -

あなたは

管理者権限を持つユーザー特権でクラスターにログインしました。 - ネットワークポリシーが適用される namespace で作業している。

手順

すべての namespace におけるすべての Pod からの Ingress を拒否する

deny-by-defaultポリシーを定義する次の YAML を作成します。YAML をdeny-by-default.yamlファイルに保存します。kind: NetworkPolicy apiVersion: networking.k8s.io/v1 metadata: name: deny-by-default namespace: my-project spec: podSelector: {} ingress: []ここでは、以下のようになります。

namespace-

ポリシーをデプロイする namespace を指定します。たとえば、

my-project という名前空間。 podSelector-

このフィールドが空の場合、設定はすべての Pod と一致します。したがって、このポリシーは

my-project名前空間内のすべての Pod に適用されます。 ingress-

[]は、イングレスルールが指定されていないことを示します。これにより、すべての Pod への受信トラフィックがドロップされます。

次のコマンドを入力して、ポリシーを適用します。正常に処理された場合、ポリシーオブジェクトの名前と

作成ステータスが表示されます。$ oc apply -f deny-by-default.yaml

3.2.4. 外部クライアントからのトラフィックを許可するネットワークポリシーの作成

deny-by-default ポリシーを設定すると、外部クライアントからラベル app=web を持つ Pod へのトラフィックを許可するポリシーの設定に進むことができます。

cluster-admin ロールを持つユーザーでログインしている場合、クラスター内の namespace でネットワークポリシーを作成できます。

この手順に従って、パブリックインターネットから直接、またはロードバランサーを使用して Pod にアクセスすることにより、外部サービスを許可するポリシーを設定します。トラフィックは、ラベル app=web を持つ Pod にのみ許可されます。

前提条件

-

クラスターが、

mode: NetworkPolicyが設定されたNetworkPolicyオブジェクトをサポートするネットワークプラグイン (OVN-Kubernetes ネットワークプラグインなど) を使用している。 -

OpenShift CLI (

oc) がインストールされている。 -

あなたは

管理者権限を持つユーザー特権でクラスターにログインしました。 - ネットワークポリシーが適用される namespace で作業している。

手順

パブリックインターネットからのトラフィックが直接、またはロードバランサーを使用して Pod にアクセスできるようにするポリシーを作成します。YAML を

web-allow-external.yamlファイルに保存します。kind: NetworkPolicy apiVersion: networking.k8s.io/v1 spec: policyTypes: - Ingress podSelector: matchLabels: app: web ingress: - {}次のコマンドを入力して、ポリシーを適用します。正常に処理された場合、ポリシーオブジェクトの名前と

作成ステータスが表示されます。$ oc apply -f web-allow-external.yamlこのポリシーは、次の図に示すように、外部トラフィックを含むすべてのリソースからのトラフィックを許可します。

3.2.5. すべての namespace からアプリケーションへのトラフィックを許可するネットワークポリシーを作成する

全 namespace 内の全 Pod から特定のアプリケーションへのトラフィックを許可するポリシーを設定できます。

cluster-admin ロールを持つユーザーでログインしている場合、クラスター内の namespace でネットワークポリシーを作成できます。

前提条件

-

クラスターが、

mode: NetworkPolicyが設定されたNetworkPolicyオブジェクトをサポートするネットワークプラグイン (OVN-Kubernetes ネットワークプラグインなど) を使用している。 -

OpenShift CLI (

oc) がインストールされている。 -

あなたは

管理者権限を持つユーザー特権でクラスターにログインしました。 - ネットワークポリシーが適用される namespace で作業している。

手順

すべての namespace のすべての Pod から特定のアプリケーションへのトラフィックを許可するポリシーを作成します。YAML を

web-allow-all-namespaces.yamlファイルに保存します。apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: web-allow-all-namespaces namespace: default spec: podSelector: matchLabels: app: web policyTypes: - Ingress ingress: - from: - namespaceSelector: {}ここでは、以下のようになります。

app-

デフォルト名前空間の

app:webPod にのみポリシーを適用します。 namespaceSelectorすべての namespace のすべての Pod を選択します。

注記デフォルトでは、ポリシーオブジェクトで

namespaceSelectorパラメーターを指定しない場合、名前空間は選択されません。これは、そのネットワークポリシーがデプロイされている namespace からのみのトラフィックを許可することを意味します。

次のコマンドを入力して、ポリシーを適用します。正常に処理された場合、ポリシーオブジェクトの名前と

作成ステータスが表示されます。$ oc apply -f web-allow-all-namespaces.yaml

検証

次のコマンドを入力して、

defaultの名前空間で Web サービスを開始します。$ oc run web --namespace=default --image=nginx --labels="app=web" --expose --port=80次のコマンドを実行して、

alpineイメージをsecondary名前空間にデプロイし、シェルを開始します。$ oc run test-$RANDOM --namespace=secondary --rm -i -t --image=alpine -- shシェルで次のコマンドを実行し、サービスがリクエストを許可することを確認します。

# wget -qO- --timeout=2 http://web.default<!DOCTYPE html> <html> <head> <title>Welcome to nginx!</title> <style> html { color-scheme: light dark; } body { width: 35em; margin: 0 auto; font-family: Tahoma, Verdana, Arial, sans-serif; } </style> </head> <body> <h1>Welcome to nginx!</h1> <p>If you see this page, the nginx web server is successfully installed and working. Further configuration is required.</p> <p>For online documentation and support please refer to <a href="http://nginx.org/">nginx.org</a>.<br/> Commercial support is available at <a href="http://nginx.com/">nginx.com</a>.</p> <p><em>Thank you for using nginx.</em></p> </body> </html>

3.2.6. namespace からアプリケーションへのトラフィックを許可するネットワークポリシーの作成

特定の名前空間から、ラベルが アプリケーション=web の Pod へのトラフィックを許可するポリシーを設定できます。この設定は、次のユースケースで役立ちます。

- 実稼働データベースへのトラフィックを、実稼働ワークロードがデプロイされている namespace のみに制限します。

- 特定の namespace にデプロイされた監視ツールを有効にして、現在の namespace からメトリクスをスクレイピングします。

cluster-admin ロールを持つユーザーでログインしている場合、クラスター内の namespace でネットワークポリシーを作成できます。

前提条件

-

クラスターが、

mode: NetworkPolicyが設定されたNetworkPolicyオブジェクトをサポートするネットワークプラグイン (OVN-Kubernetes ネットワークプラグインなど) を使用している。 -

OpenShift CLI (

oc) がインストールされている。 -

あなたは

管理者権限を持つユーザー特権でクラスターにログインしました。 - ネットワークポリシーが適用される namespace で作業している。

network.openshift.io/policy-group: ingress ラベルをカスタム名前空間またはプロジェクトに適用しないでください。このラベルは Operator が管理し、OpenShift Container Platform のネットワーク機能専用です。システムによって作成された名前空間では、これを変更してはいけません。

このラベルを使用すると、断続的なネットワーク接続の切断、意図しないシステム NetworkPolicies リソースの適用、またはオペレーターが状態を調整しようとする際に設定のずれが発生する可能性があります。カスタムトラフィックグループを作成する場合は、必ず以下の手順に示すように、一意のユーザー定義ラベルを使用してください。

手順

ラベルが

Purpose=productionの特定の名前空間内のすべての Pod からのトラフィックを許可するポリシーを作成します。YAML をweb-allow-prod.yamlファイルに保存します。kind: NetworkPolicy apiVersion: networking.k8s.io/v1 metadata: name: web-allow-prod namespace: default spec: podSelector: matchLabels: app: web policyTypes: - Ingress ingress: - from: - namespaceSelector: matchLabels: purpose: productionここでは、以下のようになります。

app-

デフォルトの名前空間の

app:webPod にのみポリシーを適用します。 purpose-

ラベルが

purpose=productionの名前空間内の Pod のみにトラフィックを制限します。

次のコマンドを入力して、ポリシーを適用します。正常に処理された場合、ポリシーオブジェクトの名前と

作成ステータスが表示されます。$ oc apply -f web-allow-prod.yaml

検証

次のコマンドを入力して、

defaultの名前空間で Web サービスを開始します。$ oc run web --namespace=default --image=nginx --labels="app=web" --expose --port=80次のコマンドを実行して、

prodnamespace を作成します。$ oc create namespace prod次のコマンドを実行して、

prod名前空間にラベルを付けます。$ oc label namespace/prod purpose=production次のコマンドを実行して、

dev名前空間を作成します。$ oc create namespace dev次のコマンドを実行して、

dev名前空間にラベルを付けます。$ oc label namespace/dev purpose=testing次のコマンドを実行して、

alpineイメージをdev名前空間にデプロイし、シェルを開始します。$ oc run test-$RANDOM --namespace=dev --rm -i -t --image=alpine -- shシェルで次のコマンドを実行し、ブロックされた要求の理由を確認します。たとえば、期待される出力は

wget: download timed out です。# wget -qO- --timeout=2 http://web.default次のコマンドを実行して、

alpineイメージをprodnamespace にデプロイし、シェルを開始します。$ oc run test-$RANDOM --namespace=prod --rm -i -t --image=alpine -- shシェルで次のコマンドを実行し、リクエストが許可されていることを確認します。

# wget -qO- --timeout=2 http://web.default<!DOCTYPE html> <html> <head> <title>Welcome to nginx!</title> <style> html { color-scheme: light dark; } body { width: 35em; margin: 0 auto; font-family: Tahoma, Verdana, Arial, sans-serif; } </style> </head> <body> <h1>Welcome to nginx!</h1> <p>If you see this page, the nginx web server is successfully installed and working. Further configuration is required.</p> <p>For online documentation and support please refer to <a href="http://nginx.org/">nginx.org</a>.<br/> Commercial support is available at <a href="http://nginx.com/">nginx.com</a>.</p> <p><em>Thank you for using nginx.</em></p> </body> </html>

3.3. ネットワークポリシーの表示

クラスター管理者は、namespace のネットワークポリシーを表示できます。

3.3.1. NetworkPolicy オブジェクトの例

以下は、NetworkPolicy オブジェクトの設定例に解説を付けたものです。

kind: NetworkPolicy

apiVersion: networking.k8s.io/v1

metadata:

name: allow-27107

spec:

podSelector:

matchLabels:

app: mongodb

ingress:

- from:

- podSelector:

matchLabels:

app: app

ports:

- protocol: TCP

port: 27017ここでは、以下のようになります。

name- NetworkPolicy オブジェクトの名前。

spec.podSelector- ポリシーが適用される Pod を説明するセレクター。ポリシーオブジェクトは NetworkPolicy オブジェクトが定義されるプロジェクトの Pod のみを選択できます。

ingress.from.podSelector- ポリシーオブジェクトが入力トラフィックを許可する Pod に一致するセレクター。セレクターは、NetworkPolicy と同じ namespace にある Pod を照合して検索します。

ingress.ports- トラフィックを受け入れる 1 つ以上の宛先ポートのリスト。

3.3.2. CLI を使用したネットワークポリシーの表示

namespace のネットワークポリシーを検査できます。

cluster-admin 特権でログインすると、クラスター内の任意のネームスペースのネットワークポリシーを編集できます。

cluster-admin 特権でログインすると、クラスター内の任意のネームスペースのネットワークポリシーを編集できます。Web コンソールでは、YAML 形式で直接ポリシーを編集するか、アクション メニューを使用して編集できます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

admin権限を持つユーザーとしてクラスターにログインしている。 - ネットワークポリシーが存在する namespace で作業している。

手順

namespace 内のネットワークポリシーをリスト表示します。

次のコマンドを入力し、namespace 内に定義されているネットワークポリシーオブジェクトを表示します。

$ oc get networkpolicyオプション: 特定のネットワークポリシーを調べるには、次のコマンドを入力します。

$ oc describe networkpolicy <policy_name> -n <namespace>ここでは、以下のようになります。

<policy_name>- 検査するネットワークポリシーの名前を指定します。

<namespace>オプション: オブジェクトが現在の namespace 以外の namespace に定義されている場合は namespace を指定します。

$ oc describe networkpolicy allow-same-namespaceName: allow-same-namespace Namespace: ns1 Created on: 2021-05-24 22:28:56 -0400 EDT Labels: <none> Annotations: <none> Spec: PodSelector: <none> (Allowing the specific traffic to all pods in this namespace) Allowing ingress traffic: To Port: <any> (traffic allowed to all ports) From: PodSelector: <none> Not affecting egress traffic Policy Types: Ingress

3.4. ネットワークポリシーの編集

クラスター管理者は、namespace の既存のネットワークポリシーを編集できます。

3.4.1. ネットワークポリシーの編集

既存のポリシー設定を変更するには、名前空間内のネットワークポリシーを編集します。ポリシーを編集するには、ポリシーファイルを変更して oc apply コマンド で適用するか、oc edit コマンドを直接使用します。

cluster-admin 特権でログインすると、クラスター内の任意のネームスペースのネットワークポリシーを編集できます。

cluster-admin 特権でログインすると、クラスター内の任意のネームスペースのネットワークポリシーを編集できます。Web コンソールでは、YAML 形式で直接ポリシーを編集するか、アクション メニューを使用して編集できます。

前提条件

-

クラスターが、

mode: NetworkPolicyが設定されたNetworkPolicyオブジェクトをサポートするネットワークプラグイン (OVN-Kubernetes ネットワークプラグインなど) を使用している。 -

OpenShift CLI (

oc) がインストールされている。 -

admin権限を持つユーザーとしてクラスターにログインしている。 - ネットワークポリシーが存在する namespace で作業している。

手順

オプション: namespace のネットワークポリシーオブジェクトをリスト表示するには、以下のコマンドを入力します。

$ oc get network policy -n <namespace>ここでは、以下のようになります。

<namespace>- オプション: オブジェクトが現在の namespace 以外の namespace に定義されている場合は namespace を指定します。

ネットワークポリシーオブジェクトを編集します。

ネットワークポリシーの定義をファイルに保存した場合は、ファイルを編集して必要な変更を加えてから、以下のコマンドを入力します。

$ oc apply -n <namespace> -f <policy_file>.yamlここでは、以下のようになります。

<namespace>- オプション: オブジェクトが現在の namespace 以外の namespace に定義されている場合は namespace を指定します。

<policy_file>- ネットワークポリシーを含むファイルの名前を指定します。

ネットワークポリシーオブジェクトを直接更新する必要がある場合、以下のコマンドを入力できます。

$ oc edit network policy <policy_name> -n <namespace>ここでは、以下のようになります。

<policy_name>- ネットワークポリシーの名前を指定します。

<namespace>- オプション: オブジェクトが現在の namespace 以外の namespace に定義されている場合は namespace を指定します。

ネットワークポリシーオブジェクトが更新されていることを確認します。

$ oc describe networkpolicy <policy_name> -n <namespace>ここでは、以下のようになります。

<policy_name>- ネットワークポリシーの名前を指定します。

<namespace>- オプション: オブジェクトが現在の namespace 以外の namespace に定義されている場合は namespace を指定します。

3.4.2. NetworkPolicy オブジェクトの例

以下は、NetworkPolicy オブジェクトの設定例に解説を付けたものです。

kind: NetworkPolicy

apiVersion: networking.k8s.io/v1

metadata:

name: allow-27107

spec:

podSelector:

matchLabels:

app: mongodb

ingress:

- from:

- podSelector:

matchLabels:

app: app

ports:

- protocol: TCP

port: 27017ここでは、以下のようになります。

name- NetworkPolicy オブジェクトの名前。

spec.podSelector- ポリシーが適用される Pod を説明するセレクター。ポリシーオブジェクトは NetworkPolicy オブジェクトが定義されるプロジェクトの Pod のみを選択できます。

ingress.from.podSelector- ポリシーオブジェクトが入力トラフィックを許可する Pod に一致するセレクター。セレクターは、NetworkPolicy と同じ namespace にある Pod を照合して検索します。

ingress.ports- トラフィックを受け入れる 1 つ以上の宛先ポートのリスト。

3.5. ネットワークポリシーの削除

クラスター管理者は、namespace からネットワークポリシーを削除できます。

3.5.1. CLI を使用したネットワークポリシーの削除

namespace のネットワークポリシーを削除できます。

cluster-admin 特権でログインすると、クラスター内の任意の名前空間にあるネットワークポリシーを削除できます。

cluster-admin 特権でログインすると、クラスター内の任意の名前空間にあるネットワークポリシーを削除できます。Web コンソールでは、YAML 形式で直接ポリシーを削除するか、アクション メニューを使用してポリシーを削除できます。

前提条件

-

クラスターが、

mode: NetworkPolicyが設定されたNetworkPolicyオブジェクトをサポートするネットワークプラグイン (OVN-Kubernetes ネットワークプラグインなど) を使用している。 -

OpenShift CLI (

oc) がインストールされている。 -

あなたは

管理者権限を持つユーザー特権でクラスターにログインしました。 - ネットワークポリシーが存在する namespace で作業している。

手順

ネットワークポリシーオブジェクトを削除するには、以下のコマンドを入力します。正常に処理された場合、ポリシーオブジェクトの名前と

削除ステータスが表示されます。$ oc delete networkpolicy <policy_name> -n <namespace>ここでは、以下のようになります。

<policy_name>- ネットワークポリシーの名前を指定します。

<namespace>- オプションのパラメーター。現在の namespace とは異なる namespace でオブジェクトを定義した場合、パラメーターは namespace を指定します。

3.6. プロジェクトのデフォルトネットワークポリシーの定義

クラスター管理者は、新規プロジェクトの作成時にネットワークポリシーを自動的に含めるように新規プロジェクトテンプレートを変更できます。新規プロジェクトのカスタマイズされたテンプレートがまだない場合には、まずテンプレートを作成する必要があります。

3.6.1. 新規プロジェクトのテンプレートの変更

クラスター管理者は、デフォルトのプロジェクトテンプレートを変更し、新規プロジェクトをカスタム要件に基づいて作成できます。

独自のカスタムプロジェクトテンプレートを作成するには、以下を実行します。

前提条件

-

cluster-adminパーミッションを持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできる。

手順

-

cluster-admin権限を持つユーザーとしてログインします。 デフォルトのプロジェクトテンプレートを生成します。

$ oc adm create-bootstrap-project-template -o yaml > template.yaml-

オブジェクトを追加するか、既存オブジェクトを変更することにより、テキストエディターで生成される

template.yamlファイルを変更します。 プロジェクトテンプレートは、

openshift-confignamespace に作成する必要があります。変更したテンプレートを読み込みます。$ oc create -f template.yaml -n openshift-configWeb コンソールまたは CLI を使用し、プロジェクト設定リソースを編集します。

Web コンソールの使用

- Administration → Cluster Settings ページに移動します。

- Configuration をクリックし、すべての設定リソースを表示します。

- Project のエントリーを見つけ、Edit YAML をクリックします。

CLI の使用

project.config.openshift.io/clusterリソースを編集します。$ oc edit project.config.openshift.io/cluster

specセクションを、projectRequestTemplateおよびnameパラメーターを組み込むように更新し、アップロードされたプロジェクトテンプレートの名前を設定します。デフォルト名はproject-requestです。カスタムプロジェクトテンプレートを含むプロジェクト設定リソース

apiVersion: config.openshift.io/v1 kind: Project metadata: # ... spec: projectRequestTemplate: name: <template_name> # ...- 変更を保存した後、変更が正常に適用されたことを確認するために、新しいプロジェクトを作成します。

3.6.2. 新規プロジェクトへのネットワークポリシーの追加

クラスター管理者は、ネットワークポリシーを新規プロジェクトのデフォルトテンプレートに追加できます。OpenShift Container Platform は、プロジェクトのテンプレートに指定されたすべての NetworkPolicy オブジェクトを自動的に作成します。

前提条件

-

クラスターが、OVN-Kubernetes などの

NetworkPolicyオブジェクトをサポートするデフォルトの Container Network Interface (CNI) ネットワークプラグインを使用している。 -

OpenShift CLI (

oc) がインストールされている。 -

cluster-admin権限を持つユーザーとしてクラスターにログインする。 - 新規プロジェクトのカスタムデフォルトプロジェクトテンプレートを作成している。

手順

以下のコマンドを実行して、新規プロジェクトのデフォルトテンプレートを編集します。

$ oc edit template <project_template> -n openshift-config<project_template>を、クラスターに設定したデフォルトテンプレートの名前に置き換えます。デフォルトのテンプレート名はproject-requestです。テンプレートでは、各

NetworkPolicyオブジェクトを要素としてobjectsパラメーターに追加します。objectsパラメーターは、1 つ以上のオブジェクトのコレクションを受け入れます。以下の例では、

objectsパラメーターのコレクションにいくつかのNetworkPolicyオブジェクトが含まれます。objects: - apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: allow-from-same-namespace spec: podSelector: {} ingress: - from: - podSelector: {} - apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: allow-from-openshift-ingress spec: ingress: - from: - namespaceSelector: matchLabels: policy-group.network.openshift.io/ingress: podSelector: {} policyTypes: - Ingress - apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: allow-from-kube-apiserver-operator spec: ingress: - from: - namespaceSelector: matchLabels: kubernetes.io/metadata.name: openshift-kube-apiserver-operator podSelector: matchLabels: app: kube-apiserver-operator policyTypes: - Ingress ...オプション: 新しいプロジェクトを作成し、ネットワークポリシーオブジェクトが正常に作成されたことを確認します。

プロジェクトを新規作成します。

$ oc new-project <project>1 - 1

<project>を、作成しているプロジェクトの名前に置き換えます。

新規プロジェクトテンプレートのネットワークポリシーオブジェクトが新規プロジェクトに存在することを確認します。

$ oc get networkpolicy想定される出力:

NAME POD-SELECTOR AGE allow-from-openshift-ingress <none> 7s allow-from-same-namespace <none> 7s

3.7. ネットワークポリシーを使用したマルチテナント分離の設定

クラスター管理者は、マルチテナントネットワークの分離を実行するようにネットワークポリシーを設定できます。

このセクションで説明するようにネットワークポリシーを設定すると、以前のバージョンの OpenShift Container Platform における OpenShift SDN のマルチテナントモードと同様のネットワーク分離が実現します。

3.7.1. ネットワークポリシーを使用したマルチテナント分離の設定

他のプロジェクト namespace の Pod およびサービスから分離できるようにプロジェクトを設定できます。

前提条件

-

クラスターが、

mode: NetworkPolicyが設定されたNetworkPolicyオブジェクトをサポートするネットワークプラグイン (OVN-Kubernetes ネットワークプラグインなど) を使用している。 -

OpenShift CLI (

oc) がインストールされている。 -

admin権限を持つユーザーとしてクラスターにログインしている。

手順

以下の

NetworkPolicyオブジェクトを作成します。allow-from-openshift-ingressという名前のポリシー:$ cat << EOF| oc create -f - apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: allow-from-openshift-ingress spec: ingress: - from: - namespaceSelector: matchLabels: policy-group.network.openshift.io/ingress: "" podSelector: {} policyTypes: - Ingress EOF注記policy-group.network.openshift.io/ingress: ""は、OVN-Kubernetes の推奨される namespace セレクターラベルです。allow-from-openshift-monitoringという名前のポリシー。$ cat << EOF| oc create -f - apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: allow-from-openshift-monitoring spec: ingress: - from: - namespaceSelector: matchLabels: network.openshift.io/policy-group: monitoring podSelector: {} policyTypes: - Ingress EOFallow-same-namespaceという名前のポリシー:$ cat << EOF| oc create -f - kind: NetworkPolicy apiVersion: networking.k8s.io/v1 metadata: name: allow-same-namespace spec: podSelector: ingress: - from: - podSelector: {} EOFallow-from-kube-apiserver-operatorという名前のポリシー:$ cat << EOF| oc create -f - apiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: allow-from-kube-apiserver-operator spec: ingress: - from: - namespaceSelector: matchLabels: kubernetes.io/metadata.name: openshift-kube-apiserver-operator podSelector: matchLabels: app: kube-apiserver-operator policyTypes: - Ingress EOF詳細は、新規の New

kube-apiserver-operatorwebhook controller validating health of webhook を参照してください。