カーネルの管理、監視、および更新

Red Hat Enterprise Linux 8 上で Linux カーネルを管理するためのガイド

概要

Red Hat ドキュメントへのフィードバック (英語のみ)

Red Hat ドキュメントに関するご意見やご感想をお寄せください。また、改善点があればお知らせください。

Jira からのフィードバック送信 (アカウントが必要)

- Jira の Web サイトにログインします。

- 上部のナビゲーションバーで Create をクリックします。

- Summary フィールドにわかりやすいタイトルを入力します。

- Description フィールドに、ドキュメントの改善に関するご意見を記入してください。ドキュメントの該当部分へのリンクも追加してください。

- ダイアログの下部にある Create をクリックします。

第1章 Linux カーネル

Linux カーネルと、Red Hat が提供および管理する Linux カーネル RPM パッケージ (Red Hat カーネル) を学びます。Red Hat カーネルを最新の状態に保ちます。これにより、オペレーティングシステムに最新のバグ修正、パフォーマンス強化、およびパッチがすべて適用され、新しいハードウェアとの互換性が保たれます。

1.1. カーネルとは

カーネルは Linux オペレーティングシステムのコア部分で、システムリソースを管理し、ハードウェアアプリケーションおよびソフトウェアアプリケーション間のインターフェイスを確立します。

Red Hat カーネルは、アップストリームの Linux メインラインカーネルをベースにしたカスタムカーネルです。Red Hat のエンジニアは、安定性と、最新のテクノロジーおよびハードウェアとの互換性に重点を置き、さらなる開発と強化を行っています。

Red Hat が新しいカーネルバージョンをリリースする前に、カーネルは厳格な品質保証テストをクリアしなければなりません。

Red Hat カーネルは RPM 形式でパッケージ化されているため、YUM パッケージマネージャーにより簡単にアップグレードおよび検証できます。

Red Hat によってコンパイルされていないカーネルは、Red Hat では サポートされていません。

1.2. RPM パッケージ

RPM パッケージは、ファイルのアーカイブと、これらのファイルのインストールと消去に使用されるメタデータで構成されます。具体的には、RPM パッケージには次の要素が含まれています。

- GPG 署名

- GPG 署名は、パッケージの整合性を検証するために使用されます。

- ヘッダー (パッケージのメタデータ)

- RPM パッケージマネージャーは、このメタデータを使用して、パッケージの依存関係、ファイルのインストール先、その他の情報を確認します。

- ペイロード

-

ペイロードは、システムにインストールするファイルを含む

cpioアーカイブです。

RPM パッケージには 2 つの種類があります。いずれも、同じファイル形式とツールを使用しますが、コンテンツが異なるため、目的が異なります。

ソース RPM (SRPM)

SRPM には、ソースコードと、ソースコードをバイナリー RPM にビルドする方法を記述した

specファイルが含まれています。必要に応じて、SRPM にはソースコードへのパッチを含めることができます。バイナリー RPM

バイナリー RPM には、ソースおよびパッチから構築されたバイナリーが含まれます。

1.3. Linux カーネル RPM パッケージの概要

カーネル RPM は、ファイルを含まないメタパッケージで、以下の必須サブパッケージが正しくインストールされるようにします。

kernel-core-

カーネルのバイナリーイメージ、システムをブートストラップするためのすべての

initramfs関連オブジェクト、およびコア機能を確保するための最小限の数のカーネルモジュールを提供します。このサブパッケージ単体は、仮想環境およびクラウド環境で使用して、Red Hat Enterprise Linux 8 カーネルのブート時間を短縮し、ディスクサイズを抑えます。 kernel-modules-

kernel-coreに存在しない残りのカーネルモジュールを提供します。

上記の kernel サブパッケージをいくつか用意することで、特に仮想環境やクラウド環境でのシステム管理者へのメンテナンス面を低減させることを目指します。

オプションのカーネルパッケージの例:

kernel-modules-extra- 希少なハードウェア用のカーネルモジュールを提供します。このモジュールのロードはデフォルトで無効になっています。

kernel-debug- カーネル診断用に多くのデバッグオプションが有効になっているカーネルを提供しますが、これによりパフォーマンスが低下します。

kernel-tools- Linux カーネルを操作するためのツールとサポートドキュメントを提供します。

kernel-devel-

kernelパッケージに対してモジュールをビルドするのに十分なカーネルヘッダーと makefile を提供します。 kernel-abi-stablelists-

RHEL カーネル ABI に関連する情報を提供します。これには、外部 Linux カーネルモジュールが必要とするカーネルシンボルのリストや、強化を支援するための

yumプラグインが含まれます。 kernel-headers- Linux カーネルと、ユーザー空間ライブラリーおよびプログラムとの間のインターフェイスを指定する C ヘッダーファイルが含まれます。ヘッダーファイルは、ほとんどの標準プログラムをビルドするのに必要な構造と定数を定義します。

1.4. カーネルパッケージの内容の表示

リポジトリーをクエリーすると、カーネルパッケージがモジュールなどの特定のファイルを提供しているかどうかを確認できます。ファイルリストを表示するためにパッケージをダウンロードまたはインストールする必要はありません。

dnf ユーティリティーを使用して、たとえば kernel-core、kernel-modules-core、または kernel-modules パッケージのファイルリストをクエリーします。kernel パッケージはファイルを含まないメタパッケージであることに注意してください。

手順

パッケージの利用可能なバージョンをリスト表示します。

yum repoquery <package_name>

$ yum repoquery <package_name>Copy to Clipboard Copied! Toggle word wrap Toggle overflow パッケージ内のファイルをリスト表示します。

yum repoquery -l <package_name>

$ yum repoquery -l <package_name>Copy to Clipboard Copied! Toggle word wrap Toggle overflow

1.5. 特定のカーネルバージョンのインストール

yum パッケージマネージャーを使用して新しいカーネルをインストールします。

手順

特定のカーネルバージョンをインストールするには、次のコマンドを実行します。

yum install kernel-5.14.0

# yum install kernel-5.14.0Copy to Clipboard Copied! Toggle word wrap Toggle overflow

1.6. カーネルの更新

yum パッケージマネージャーを使用してカーネルを更新します。

手順

カーネルを更新するには、次のコマンドを入力します。

yum update kernel

# yum update kernelCopy to Clipboard Copied! Toggle word wrap Toggle overflow このコマンドは、カーネルと、利用可能な最新バージョンへのすべての依存関係を更新します。

- システムを再起動して、変更を有効にします。

RHEL 7 から RHEL 8 にアップグレードする場合は、RHEL 7 から RHEL 8 へのアップグレード ドキュメントの関連のセクションを参照してください。

1.7. カーネルのデフォルトとしての設定

grubby コマンドラインツールと GRUB を使用して、特定のカーネルをデフォルトとして設定します。

手順

grubbyツールを使用し、デフォルトとしてカーネルを設定する以下のコマンドを実行し、

grubbyツールを使用してカーネルをデフォルトとして設定します。grubby --set-default $kernel_path

# grubby --set-default $kernel_pathCopy to Clipboard Copied! Toggle word wrap Toggle overflow コマンドは、

.confの接尾辞のないマシン ID を引数として使用します。注記マシン ID は

/boot/loader/entries/ディレクトリーにあります。

id引数を使用し、デフォルトとしてカーネルを設定するid引数を使用してブートエントリーのリストを表示し、任意のカーネルをデフォルトとして設定します。grubby --info ALL | grep id grubby --set-default /boot/vmlinuz-<version>.<architecture>

# grubby --info ALL | grep id # grubby --set-default /boot/vmlinuz-<version>.<architecture>Copy to Clipboard Copied! Toggle word wrap Toggle overflow 注記title引数を使用してブートエントリーのリストを表示するには、# grubby --info=ALL | grep titleコマンドを実行します。

次回の起動時のみ用にデフォルトのカーネルを設定する

次のコマンドを実行し、

grub2-rebootコマンドを使用して、次回の再起動限定でデフォルトのカーネルを設定します。grub2-reboot <index|title|id>

# grub2-reboot <index|title|id>Copy to Clipboard Copied! Toggle word wrap Toggle overflow 警告取り扱いに注意して、次回の起動時限定のデフォルトのカーネルを設定します。新しいカーネル RPM、自己ビルドカーネルをインストールし、エントリーを

/boot/loader/entries/ディレクトリーに手動で追加すると、インデックス値が変更される可能性があります。

第2章 カーネルモジュールの管理

カーネルモジュール、それらの情報を表示する方法、およびカーネルモジュールを使用して基本的な管理タスクを実行する方法を学びます。

2.1. モジュールの紹介

Red Hat Enterprise Linux カーネルはカーネルモジュールを使用して拡張でき、システムを再起動せずにオプションの追加機能を提供します。RHEL 8 では、カーネルモジュールは追加のカーネルコードで、圧縮された <KERNEL_MODULE_NAME>.ko.xz オブジェクトファイルに組み込まれています。

カーネルモジュールにより有効になっている最も一般的な機能は、以下のとおりです。

- 新しいハードウェアのサポートを追加するデバイスドライバー

- GFS2 や NFS などのファイルシステムのサポート

- システムコール

最新のシステムでは、必要に応じて自動的にカーネルモジュールが読み込まれます。ただし、場合によっては、モジュールを手動でロードまたはアンロードする必要があります。

カーネルと同様に、モジュールは動作をカスタマイズするパラメーターを受け入れます。

カーネルツールを使用して、モジュールに対して次のアクションを実行できます。

- 現在実行中のモジュールを検査する。

- カーネルにロードできるモジュールを検査する。

- モジュールが受け入れるパラメーターを検査する。

- 実行中のカーネルにカーネルモジュールをロードおよびアンロードするメカニズムを有効化する。

2.2. カーネルモジュールの依存関係

カーネルモジュールによっては、1 つ以上の他のカーネルモジュールに依存するものもあります。/lib/modules/<KERNEL_VERSION>/modules.dep ファイルには、対応するカーネルバージョンに対するカーネルモジュールの依存関係の完全なリストが含まれます。

depmod

依存関係ファイルは、kmod パッケージに含まれる depmod プログラムによって生成されます。kmod によって提供される多くのユーティリティーは、操作を実行するときにモジュールの依存関係を考慮します。したがって、手動 での依存関係の追跡は、ほとんど必要ありません。

カーネルモジュールのコードは、カーネル空間で無制限モードで実行されます。どのモジュールを読み込んでいるかに注意してください。

weak-modules

depmod に加えて、Red Hat Enterprise Linux は、kmod パッケージの一部である weak-modules スクリプトを提供します。weak-modules は、インストールされているカーネルと kABI 互換性のあるモジュールを決定します。モジュールカーネルの互換性をチェックしている間、weak-modules はモジュールシンボルの依存関係を、それらがビルドされたカーネルの上位リリースから下位リリースへと処理します。カーネルのリリースとは独立して各モジュールを処理します。

2.3. インストール済みカーネルモジュールのリスト表示

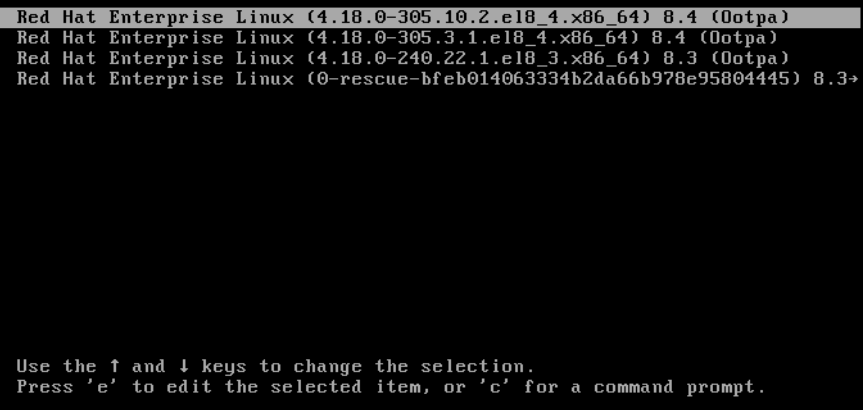

grubby --info=ALL コマンドは、!BLS インストールおよび BLS インストールにインストールされたカーネルのインデックスリストを表示します。

手順

以下のコマンドを使用して、インストールされているカーネルをリスト表示します。

grubby --info=ALL | grep title

# grubby --info=ALL | grep titleCopy to Clipboard Copied! Toggle word wrap Toggle overflow インストールされているカーネルのリストは、以下のようになります。

title=Red Hat Enterprise Linux (4.18.0-20.el8.x86_64) 8.0 (Ootpa) title=Red Hat Enterprise Linux (4.18.0-19.el8.x86_64) 8.0 (Ootpa) title=Red Hat Enterprise Linux (4.18.0-12.el8.x86_64) 8.0 (Ootpa) title=Red Hat Enterprise Linux (4.18.0) 8.0 (Ootpa) title=Red Hat Enterprise Linux (0-rescue-2fb13ddde2e24fde9e6a246a942caed1) 8.0 (Ootpa)

title=Red Hat Enterprise Linux (4.18.0-20.el8.x86_64) 8.0 (Ootpa) title=Red Hat Enterprise Linux (4.18.0-19.el8.x86_64) 8.0 (Ootpa) title=Red Hat Enterprise Linux (4.18.0-12.el8.x86_64) 8.0 (Ootpa) title=Red Hat Enterprise Linux (4.18.0) 8.0 (Ootpa) title=Red Hat Enterprise Linux (0-rescue-2fb13ddde2e24fde9e6a246a942caed1) 8.0 (Ootpa)Copy to Clipboard Copied! Toggle word wrap Toggle overflow

これは、GRUB メニューからの grubby-8.40-17 のインストール済みカーネルのリストです。

2.4. 現在読み込み済みカーネルモジュールのリスト表示

現在ロードされているカーネルモジュールを表示します。

前提条件

-

kmodパッケージがインストールされている。

手順

現在読み込み済みのカーネルモジュールの一覧を表示するには、以下のコマンドを実行します。

Copy to Clipboard Copied! Toggle word wrap Toggle overflow 上記の例では、以下のようになります。

-

Module列は、現在読み込まれているモジュールの 名前 を示します。 -

Size列は、モジュールごとの メモリー 容量をキロバイト単位で表示します。 -

Used by列には、特定のモジュールに 依存する モジュールの数と、オプションで名前が表示されます。

-

2.5. インストール済みカーネルのリスト表示

grubby ユーティリティーを使用して、システムにインストールされているすべてのカーネルを一覧表示します。

前提条件

- root 権限がある。

手順

インストールされているすべてのカーネルを一覧表示するには、次のコマンドを実行します。

grubby --info=ALL | grep ^kernel

# grubby --info=ALL | grep ^kernel kernel="/boot/vmlinuz-4.18.0-305.10.2.el8_4.x86_64" kernel="/boot/vmlinuz-4.18.0-240.el8.x86_64" kernel="/boot/vmlinuz-0-rescue-41eb2e172d7244698abda79a51778f1b"Copy to Clipboard Copied! Toggle word wrap Toggle overflow

出力には、インストールされているすべてのカーネルのパスとバージョンが表示されます。

2.6. モジュール情報の表示

modinfo コマンドを使用して、指定したカーネルモジュールに関する詳細情報を表示します。

前提条件

-

kmodパッケージがインストールされている。

手順

カーネルモジュールの情報を表示するには、以下を実行します。

modinfo <KERNEL_MODULE_NAME>

$ modinfo <KERNEL_MODULE_NAME>Copy to Clipboard Copied! Toggle word wrap Toggle overflow 以下に例を示します。

Copy to Clipboard Copied! Toggle word wrap Toggle overflow ロードされているかどうかに関係なく、利用可能なすべてのモジュールに関する情報をクエリーできます。

parmエントリーは、ユーザーがモジュールに設定できるパラメーターと、期待される値のタイプを示します。注記カーネルモジュールの名前を入力する際には、

.ko.xz拡張子は名前の末尾に追加しないでください。カーネルモジュール名には拡張子はありません。ただし、対応するファイルには拡張子があります。

2.7. システム実行時のカーネルモジュールのロード

Linux カーネルの機能を拡張する最適な方法は、カーネルモジュールを読み込むことです。modprobe コマンドを使用して、カーネルモジュールを検出し、現在実行しているカーネルに読み込みます。

この手順で説明されている変更は、システムの再起動後は 維持されません。システムの再起動後にも 設定を維持 するようにカーネルモジュールを読み込む方法は、システムの起動時に自動的にカーネルモジュールを読み込む を参照してください。

前提条件

- root 権限がある。

-

kmodパッケージがインストールされている。 - 関連のカーネルモジュールが読み込まれていない。これが当てはまるかどうかを確認するには、現在ロードされているカーネルモジュールのリスト を表示します。

手順

読み込むカーネルモジュールを選択します。

モジュールは

/lib/modules/$(uname -r)/kernel/<SUBSYSTEM>/ディレクトリーにあります。関連するカーネルモジュールを読み込みます。

modprobe <MODULE_NAME>

# modprobe <MODULE_NAME>Copy to Clipboard Copied! Toggle word wrap Toggle overflow 注記カーネルモジュールの名前を入力する際には、

.ko.xz拡張子は名前の末尾に追加しないでください。カーネルモジュール名には拡張子はありません。ただし、対応するファイルには拡張子があります。

検証

必要に応じて、関連モジュールが読み込まれたことを確認します。

lsmod | grep <MODULE_NAME>

$ lsmod | grep <MODULE_NAME>Copy to Clipboard Copied! Toggle word wrap Toggle overflow モジュールが正しく読み込まれた場合、このコマンドは関連するカーネルモジュールを表示します。以下に例を示します。

lsmod | grep serio_raw

$ lsmod | grep serio_raw serio_raw 16384 0Copy to Clipboard Copied! Toggle word wrap Toggle overflow

2.8. システム実行時のカーネルモジュールのアンロード

実行中のカーネルから特定のカーネルモジュールをアンロードするには、modprobe コマンドを使用して、システム実行時に現在ロードされているカーネルからカーネルモジュールを検索してアンロードします。

実行中のシステムで使用されているカーネルモジュールをアンロードしないでください。システムが不安定になったり、動作しなくなったりする可能性があります。

非アクティブなカーネルモジュールのアンロードが完了すると、起動時に自動的にロードされるように定義されているモジュールは、システムの再起動後もアンロードされたままになることはありません。この結果を防ぐ方法については、システムの起動時にカーネルモジュールが自動的に読み込まれないようにするを 参照してください。

前提条件

- root 権限がある。

-

kmodパッケージがインストールされている。

手順

ロードされたすべてのカーネルモジュールをリスト表示します。

lsmod

# lsmodCopy to Clipboard Copied! Toggle word wrap Toggle overflow アンロードするカーネルモジュールを選択します。

カーネルモジュールに依存関係がある場合は、カーネルモジュールをアンロードする前に、これらをアンロードします。依存関係のあるモジュールを識別する方法の詳細は、現在ロードされているカーネルモジュールのリスト表示 および カーネルモジュールの依存関係 を参照してください。

関連するカーネルモジュールをアンロードします。

modprobe -r <MODULE_NAME>

# modprobe -r <MODULE_NAME>Copy to Clipboard Copied! Toggle word wrap Toggle overflow カーネルモジュールの名前を入力する際には、

.ko.xz拡張子は名前の末尾に追加しないでください。カーネルモジュール名には拡張子はありません。ただし、対応するファイルには拡張子があります。

検証

必要に応じて、関連モジュールがアンロードされたことを確認します。

lsmod | grep <MODULE_NAME>

$ lsmod | grep <MODULE_NAME>Copy to Clipboard Copied! Toggle word wrap Toggle overflow モジュールが正常にアンロードされる場合、このコマンドは出力を表示しません。

2.9. 起動プロセスの初期段階でのカーネルモジュールのアンロード

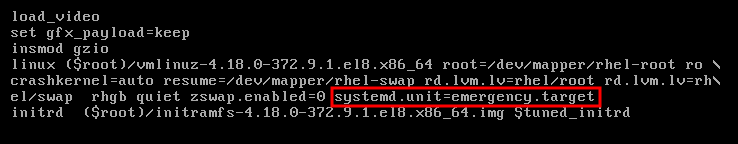

特定の状況では、たとえば、カーネルモジュールにシステムが応答しなくなるコードがあり、ユーザーが不正なカーネルモジュールを永続的に無効にする段階に到達できない場合、起動プロセスの早い段階でカーネルモジュールをアンロードする必要が出てくる場合があります。カーネルモジュールのロードを一時的にブロックするには、ブートローダーを使用します。

ブートシーケンスの続行前に、関連するブートローダーエントリーを編集して、必要なカーネルモジュールをアンロードできます。

この手順で説明されている変更は、システムを再起動すると維持されません。起動プロセス時にカーネルモジュールが自動的に読み込まれないように、denylist にカーネルモジュールを追加する方法は、システムの起動時にカーネルモジュールが自動的にロードされないようにする を参照してください。

前提条件

- なんらかの理由で読み込みを阻止する必要のある、読み込み可能なカーネルモジュールがある。

手順

- システムをブートローダーで起動します。

- カーソルキーを使用して、関連するブートローダーエントリーを強調表示します。

e キーを押してエントリーを編集します。

- カーソルキーを使用して、linux で始まる行に移動します。

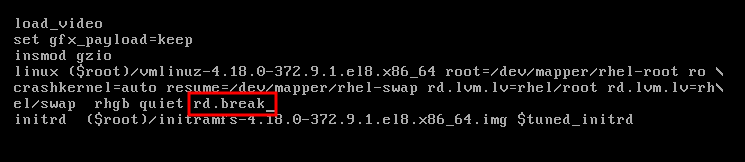

modprobe.blacklist=module_nameを行末に追加します。図2.2 カーネルブートエントリー

serio_rawカーネルモジュールは、起動プロセスの初期段階でアンロードする不正なモジュールを示しています。- Ctrl+X を押して、変更した設定を使用して起動します。

検証

システムの起動後、関連するカーネルモジュールがロードされていないことを確認します。

lsmod | grep serio_raw

# lsmod | grep serio_rawCopy to Clipboard Copied! Toggle word wrap Toggle overflow

2.10. システムの起動時にカーネルモジュールを自動的にロードする

起動プロセス中にカーネルモジュールを自動的にロードするように設定します。

前提条件

- root 権限がある。

-

kmodパッケージがインストールされている。

手順

起動プロセス中に読み込むカーネルモジュールを選択します。

モジュールは

/lib/modules/$(uname -r)/kernel/<SUBSYSTEM>/ディレクトリーにあります。モジュールの設定ファイルを作成します。

echo <MODULE_NAME> > /etc/modules-load.d/<MODULE_NAME>.conf

# echo <MODULE_NAME> > /etc/modules-load.d/<MODULE_NAME>.confCopy to Clipboard Copied! Toggle word wrap Toggle overflow 注記カーネルモジュールの名前を入力する際には、

.ko.xz拡張子は名前の末尾に追加しないでください。カーネルモジュール名には拡張子はありません。ただし、対応するファイルには拡張子があります。

検証

再起動後、関連するモジュールがロードされていることを確認します。

lsmod | grep <MODULE_NAME>

$ lsmod | grep <MODULE_NAME>Copy to Clipboard Copied! Toggle word wrap Toggle overflow

この手順で説明している変更は、システムを再起動しても 持続されます。

2.11. システムの起動時にカーネルモジュールが自動的にロードされないようにする

対応するコマンドを使用して、modprobe 設定ファイルにモジュールを一覧表示することで、起動プロセス中にシステムが自動的にカーネルモジュールを読み込むことを阻止できます。

前提条件

-

この手順のコマンドには root 権限が必要です。

su -を使用して root ユーザーに切り替えるか、コマンドの前にsudoを付けます。 -

kmodパッケージがインストールされている。 - 現在のシステム設定に、拒否する予定のカーネルモジュールが必要ないことを確認する。

手順

lsmodコマンドを使用して、現在実行中のカーネルに読み込まれているモジュールを一覧表示します。Copy to Clipboard Copied! Toggle word wrap Toggle overflow 出力で、ロードを阻止するモジュールを特定します。

または、

/lib/modules/<KERNEL-VERSION>/kernel/<SUBSYSTEM>/ディレクトリーに読み込まれないようにするアンロードしたカーネルモジュールを特定します。以下に例を示します。ls /lib/modules/4.18.0-477.20.1.el8_8.x86_64/kernel/crypto/

$ ls /lib/modules/4.18.0-477.20.1.el8_8.x86_64/kernel/crypto/ ansi_cprng.ko.xz chacha20poly1305.ko.xz md4.ko.xz serpent_generic.ko.xz anubis.ko.xz cmac.ko.xz…Copy to Clipboard Copied! Toggle word wrap Toggle overflow

拒否リストとして機能する設定ファイルを作成します。

touch /etc/modprobe.d/denylist.conf

# touch /etc/modprobe.d/denylist.confCopy to Clipboard Copied! Toggle word wrap Toggle overflow 任意のテキストエディターで、カーネルへの自動読み込みから除外するモジュール名を

blacklist設定コマンドと組み合わせます。以下に例を示します。Copy to Clipboard Copied! Toggle word wrap Toggle overflow blacklistコマンドは、モジュールが、拒否リストにない別のカーネルモジュールの依存関係としてロードされることを阻止しないため、install行も定義する必要があります。この場合、システムはモジュールをインストールする代わりに/bin/falseを実行します。ハッシュ記号で始まる行は、ファイルをより読みやすくするために使用可能なコメントです。注記カーネルモジュールの名前を入力する際には、

.ko.xz拡張子は名前の末尾に追加しないでください。カーネルモジュール名には拡張子はありません。ただし、対応するファイルには拡張子があります。再構築を行う前に、現在の初期 RAM ディスクイメージのバックアップコピーを作成します。

cp /boot/initramfs-$(uname -r).img /boot/initramfs-$(uname -r).bak.$(date +%m-%d-%H%M%S).img

# cp /boot/initramfs-$(uname -r).img /boot/initramfs-$(uname -r).bak.$(date +%m-%d-%H%M%S).imgCopy to Clipboard Copied! Toggle word wrap Toggle overflow または、カーネルモジュールの自動読み込みを阻止するカーネルバージョンに対応する初期 RAM ディスクイメージのバックアップコピーを作成します。

cp /boot/initramfs-<VERSION>.img /boot/initramfs-<VERSION>.img.bak.$(date +%m-%d-%H%M%S)

# cp /boot/initramfs-<VERSION>.img /boot/initramfs-<VERSION>.img.bak.$(date +%m-%d-%H%M%S)Copy to Clipboard Copied! Toggle word wrap Toggle overflow

新しい初期 RAM ディスクイメージを生成して、変更を適用します。

dracut -f -v

# dracut -f -vCopy to Clipboard Copied! Toggle word wrap Toggle overflow システムで現在使用中のものとは異なるカーネルバージョンの初期 RAM ディスクイメージを構築する場合は、ターゲット

initramfsとカーネルバージョンの両方を指定します。dracut -f -v /boot/initramfs-<TARGET-VERSION>.img <CORRESPONDING-TARGET-KERNEL-VERSION>

# dracut -f -v /boot/initramfs-<TARGET-VERSION>.img <CORRESPONDING-TARGET-KERNEL-VERSION>Copy to Clipboard Copied! Toggle word wrap Toggle overflow

システムを再起動します。

reboot

$ rebootCopy to Clipboard Copied! Toggle word wrap Toggle overflow

この手順で説明されている変更は、システムの再起動後も 有効なまま維持されます。重要なカーネルモジュールを誤って拒否リストに指定すると、システムが不安定または操作不能な状態になる可能性があります。

2.12. カスタムカーネルモジュールのコンパイル

ハードウェアおよびソフトウェアレベルで、さまざまな設定による要求に応じて、サンプリングカーネルモジュールを構築できます。

前提条件

kernel-develパッケージ、gccパッケージ、およびelfutils-libelf-develパッケージをインストールしている。dnf install kernel-devel-$(uname -r) gcc elfutils-libelf-devel

# dnf install kernel-devel-$(uname -r) gcc elfutils-libelf-develCopy to Clipboard Copied! Toggle word wrap Toggle overflow - root 権限がある。

-

カスタムカーネルモジュールをコンパイルする

/root/testmodule/ディレクトリーを作成している。

手順

以下の内容で

/root/testmodule/test.cを作成します。Copy to Clipboard Copied! Toggle word wrap Toggle overflow test.cファイルは、カーネルモジュールに主な機能を提供するソースファイルです。このファイルは、組織的な目的で、専用の/root/testmodule/ディレクトリーに作成されています。モジュールをコンパイルすると、/root/testmodule/ディレクトリーには複数のファイルが含まれます。test.cファイルには、システムライブラリーから次のものが含まれます。-

サンプルコードの

printk()機能には、linux/kernel.hヘッダーファイルが必要です。 -

linux/module.hヘッダーファイルには、複数の C ソースファイル間で共有される関数宣言とマクロ定義が含まれています。

-

サンプルコードの

-

次に、

init_module()関数およびcleanup_module()関数に従い、テキストを出力するカーネルロギング機能printk()を起動および終了します。 以下の内容で

/root/testmodule/Makefileを作成します。obj-m := test.o

obj-m := test.oCopy to Clipboard Copied! Toggle word wrap Toggle overflow Makefile には、コンパイラーが

test.oという名前のオブジェクトファイルを生成するための指示が含まれています。obj-mディレクティブは、生成されるtest.koファイルを、読み込み可能なカーネルモジュールとしてコンパイルすることを指定します。あるいは、obj-yディレクティブは、組み込みカーネルモジュールとしてtest.koをビルドするように指示できます。カーネルモジュールをコンパイルします。

Copy to Clipboard Copied! Toggle word wrap Toggle overflow コンパイラーは、各ソースファイル (

test.c) のオブジェクトファイル (test.o) を中間手順として作成してから、それらを最終カーネルモジュール (test.ko) にリンクします。コンパイルが成功すると、

/root/testmodule/には、コンパイル済みカスタムカーネルモジュールに関連する追加ファイルが含まれます。コンパイル済みモジュール自身は、test.koファイルで表されます。

検証

必要に応じて、

/root/testmodule/ディレクトリーのコンテンツを確認します。Copy to Clipboard Copied! Toggle word wrap Toggle overflow カーネルモジュールを

/lib/modules/$(uname -r)/ディレクトリーにコピーします。cp /root/testmodule/test.ko /lib/modules/$(uname -r)/

# cp /root/testmodule/test.ko /lib/modules/$(uname -r)/Copy to Clipboard Copied! Toggle word wrap Toggle overflow モジュールの依存関係のリストを更新します。

depmod -a

# depmod -aCopy to Clipboard Copied! Toggle word wrap Toggle overflow カーネルモジュールを読み込みます。

modprobe -v test

# modprobe -v test insmod /lib/modules/4.18.0-305.el8.x86_64/test.koCopy to Clipboard Copied! Toggle word wrap Toggle overflow カーネルモジュールが正常に読み込まれたことを確認します。

lsmod | grep test

# lsmod | grep test test 16384 0Copy to Clipboard Copied! Toggle word wrap Toggle overflow カーネルリングバッファーから最新のメッセージを読み込みます。

dmesg

# dmesg [74422.545004] Hello World This is a testCopy to Clipboard Copied! Toggle word wrap Toggle overflow

第3章 セキュアブート用のカーネルとモジュールの署名

署名済みカーネルと署名済みカーネルモジュールを使用して、システムのセキュリティーを強化できます。セキュアブートが有効になっている UEFI ベースのビルドシステムでは、プライベートにビルドされたカーネルまたはカーネルモジュールに自己署名できます。さらに、カーネルまたはカーネルモジュールをデプロイするターゲットシステムに公開鍵をインポートすることもできます。

セキュアブートが有効な場合、次のすべてのコンポーネントを秘密鍵で署名し、対応する公開鍵で認証する必要があります。

- UEFI オペレーティングシステムのブートローダー

- Red Hat Enterprise Linux カーネル

- すべてのカーネルモジュール

これらのコンポーネントのいずれかが署名および認証されていない場合、システムは起動プロセスを完了できません。

RHEL 8 には以下が含まれます。

- 署名済みブートローダー

- 署名済みカーネル

- 署名済みカーネルモジュール

さらに、署名済みの第 1 ステージのブートローダーと署名済みカーネルには、Red Hat 公開鍵が組み込まれています。これらの署名された実行可能バイナリーと埋め込みキーにより、RHEL 8 は Microsoft UEFI セキュアブート認証局キーを使用してインストール、起動、実行できるようになります。これらのキーは、UEFI セキュアブートをサポートするシステムの UEFI ファームウェアによって提供されます。

- セキュアブートのサポートは、すべての UEFI ベースのシステムに含まれるわけではありません。

- カーネルモジュールを構築、署名するビルドシステムは、UEFI セキュアブートを有効にする必要がなく、UEFI ベースのシステムである必要すらありません。

3.1. 前提条件

外部でビルドされたカーネルモジュールに署名できるようにするには、次のパッケージからユーティリティーをインストールします。

yum install pesign openssl kernel-devel mokutil keyutils

# yum install pesign openssl kernel-devel mokutil keyutilsCopy to Clipboard Copied! Toggle word wrap Toggle overflow Expand 表3.1 必要なユーティリティー ユーティリティー 提供するパッケージ 使用対象 目的 efikeygenpesignビルドシステム

公開および秘密 X.509 鍵のペアを生成

opensslopensslビルドシステム

暗号化されていない秘密鍵をエクスポートします。

sign-filekernel-develビルドシステム

秘密鍵でカーネルモジュールに署名するために使用する実行ファイル

mokutilmokutilターゲットシステム

公開鍵を手動で登録する際に使用するオプションのユーティリティー

keyctlkeyutilsターゲットシステム

システムキーリングへの公開鍵の表示時に使用するオプションのユーティリティー

3.2. UEFI セキュアブートとは

Unified Extensible Firmware Interface (UEFI) セキュアブートテクノロジーを使用すると、信頼できる鍵によって署名されていないカーネル空間コードの実行を防ぐことができます。システムブートローダーは暗号鍵で署名されています。ファームウェア内の公開鍵のデータベースは、鍵に署名するプロセスを認可します。その後、次のステージのブートローダーとカーネルで署名を検証できます。

UEFI セキュアブートは、以下のようにファームウェアから署名済みドライバーおよびカーネルモジュールへの信頼チェーンを確立します。

-

UEFI 秘密鍵が

shim第 1 ステージブートローダーに署名し、それを公開鍵が認証します。認証局 (CA) は公開鍵に署名します。CA はファームウェアのデータベースに保存されます。 -

shimファイルには、GRUB ブートローダーとカーネルを認証するための Red Hat 公開鍵 Red Hat Secure Boot (CA key 1) が含まれています。 - カーネルには、ドライバーおよびモジュールを認証する公開鍵が含まれます。

セキュアブートは、UEFI 仕様のブートパス検証コンポーネントです。この仕様は、以下を定義します。

- 揮発性ではないストレージでの暗号で保護された UEFI 変数用のプログラミングインターフェイス

- UEFI 変数での信頼できる X.509 ルート証明書の保存

- ブートローダーやドライバーなどの UEFI アプリケーションの検証

- 既知の問題のある証明書およびアプリケーションハッシュを無効にする手順

UEFI セキュアブートは、不正な変更の検出には役立ちますが、以下を行うことは できません。

- 第 2 ステージブートローダーのインストールまたは削除を防止する。

- このような変更について、ユーザーによる明示的な確認を要求する。

- ブートパスの操作を停止する。署名は、ブートローダーのインストールや更新時ではなく、起動時に検証されます。

ブートローダーまたはカーネルがシステムの信頼された鍵で署名されていない場合、セキュアブートにより起動が妨げられます。

3.3. UEFI セキュアブートのサポート

カーネルとロードされたすべてのドライバーが信頼できるキーで署名されている場合、UEFI セキュアブートが有効になっているシステムに RHEL 8 をインストールして実行できます。Red Hat は、関連する Red Hat キーによって署名および認証されたカーネルとドライバーを提供します。

外部でビルドされたカーネルまたはドライバーをロードする場合は、それらにも署名する必要があります。

UEFI セキュアブートによる制限

- システムは、署名が適切に認証された後にのみ、カーネルモードコードを実行します。

- GRUB モジュールの署名および検証を行うインフラストラクチャーがないため、GRUB モジュールの読み込みは無効です。モジュールのロードを許可すると、セキュアブートによって定義されたセキュリティー境界内で信頼できないコードが実行されます。

- Red Hat は、RHEL 8 でサポートされているすべてのモジュールを含む署名済み GRUB バイナリーを提供します。

3.4. X.509 鍵でカーネルモジュールを認証するための要件

RHEL 8 では、カーネルモジュールがロードされると、カーネルはカーネルシステムキーリング (.builtin_trusted_keys) およびカーネルプラットフォームキーリング (.platform) からの公開 X.509 キーに対してモジュールの署名をチェックします。.platform キーリングは、サードパーティーのプラットフォームプロバイダーおよびカスタム公開鍵からの鍵を提供します。カーネルシステムの .blacklist キーリングからの鍵は検証から除外されます。

UEFI セキュアブート機能が有効になっているシステムでカーネルモジュールをロードするには、特定の条件を満たす必要があります。

UEFI セキュアブートが有効な場合、または

module.sig_enforceカーネルパラメーターが指定されている場合:-

署名がシステムキーリング (

.builtin_trusted_keys) およびプラットフォームキーリング (.platform) からの鍵に対して認証されている署名済みのカーネルモジュールだけを読み込みできます。 -

公開鍵は、システムで拒否されたキーのキーリング (

.blacklist) に配置できません。

-

署名がシステムキーリング (

UEFI セキュアブートが無効で

module.sig_enforceカーネルパラメーターが指定されていない場合:- 公開鍵なしで、未署名のカーネルモジュールと署名済みカーネルモジュールを読み込むことができます。

システムが UEFI ベースでない場合、または UEFI セキュアブートが無効になっている場合:

-

カーネルに埋め込まれた鍵のみが

.builtin_trusted_keysおよび.platformに読み込まれます。 - カーネルの再構築なしでキーセットを拡張することはできません。

-

カーネルに埋め込まれた鍵のみが

| モジュールの署名 | 公開鍵ありおよび署名が有効 | UEFI セキュアブートの状態 | sig_enforce | モジュールの読み込み | カーネルのテイント |

|---|---|---|---|---|---|

| 署名なし | - | 有効でない | 有効でない | 成功 | はい |

| 有効でない | 有効 | 失敗 | - | ||

| 有効 | - | 失敗 | - | ||

| 署名あり | いいえ | 有効でない | 有効でない | 成功 | はい |

| 有効でない | 有効 | 失敗 | - | ||

| 有効 | - | 失敗 | - | ||

| 署名あり | はい | 有効でない | 有効でない | 成功 | いいえ |

| 有効でない | 有効 | 成功 | いいえ | ||

| 有効 | - | 成功 | いいえ |

3.5. 公開鍵のソース

カーネルは、起動時に X.509 キーを永続キーストアから以下のキーリングに読み込みます。

-

システムキーリング (

.builtin_trusted_keys) -

.platformキーリング -

システムの

.blacklistキーリング

| X.509 鍵のソース | ユーザーによるキーの追加 | UEFI セキュアブートの状態 | ブート中に読み込まれる鍵 |

|---|---|---|---|

| カーネルに埋め込み | いいえ | - |

|

|

UEFI | 限定的 | 有効でない | いいえ |

| 有効 |

| ||

|

| いいえ | 有効でない | いいえ |

| 有効 |

| ||

| Machine Owner Key (MOK) リスト | はい | 有効でない | いいえ |

| 有効 |

|

.builtin_trusted_keys- 起動時にビルドされるキーリング

- 信頼できる公開鍵を提供します。

-

キーを表示するには、

root権限が必要です。

.platform- 起動時にビルドされるキーリング

- サードパーティーのプラットフォームプロバイダーからの鍵とカスタムの公開鍵を提供します。

-

キーを表示するには、

root権限が必要です。

.blacklist- 失効した X.509 キーを含むキーリング

-

公開鍵が

.builtin_trusted_keysにある場合でも、.blacklistからの鍵で署名されたモジュールは認証に失敗します。

- UEFI セキュアブート

db - 署名データベース

- UEFI アプリケーション、UEFI ドライバー、およびブートローダーのキー (ハッシュ) を保存します。

- キーはマシンにロードできます。

- UEFI セキュアブート

dbx - 失効した署名データベース

- キーがロードされるのを防ぎます。

-

このデータベースからの失効したキーは、

.blacklistキーリングに追加されます。

3.6. 公開鍵と秘密鍵の生成

セキュアブート対応システムでカスタムカーネルまたはカスタムカーネルモジュールを使用するには、X.509 の公開鍵と秘密鍵のペアを生成する必要があります。生成された秘密鍵を使用して、カーネルまたはカーネルモジュールに署名できます。また、対応する公開鍵をセキュアブートの Machine Owner Key (MOK) に追加することで、署名済みのカーネルまたはカーネルモジュールを検証できます。

強力なセキュリティー対策とアクセスポリシーを適用して、秘密鍵の内容を保護します。悪用すれば、この鍵は、一致する公開鍵で認証されるシステムのセキュリティーに危害を与えるために使用できます。

手順

X.509 の公開鍵と秘密鍵のペアを作成します。

カスタムカーネル モジュール に署名するだけの場合:

efikeygen --dbdir /etc/pki/pesign \ --self-sign \ --module \ --common-name 'CN=Organization signing key' \ --nickname 'Custom Secure Boot key'# efikeygen --dbdir /etc/pki/pesign \ --self-sign \ --module \ --common-name 'CN=Organization signing key' \ --nickname 'Custom Secure Boot key'Copy to Clipboard Copied! Toggle word wrap Toggle overflow カスタム カーネル に署名する場合:

efikeygen --dbdir /etc/pki/pesign \ --self-sign \ --kernel \ --common-name 'CN=Organization signing key' \ --nickname 'Custom Secure Boot key'# efikeygen --dbdir /etc/pki/pesign \ --self-sign \ --kernel \ --common-name 'CN=Organization signing key' \ --nickname 'Custom Secure Boot key'Copy to Clipboard Copied! Toggle word wrap Toggle overflow RHEL システムが FIPS モードを実行している場合:

Copy to Clipboard Copied! Toggle word wrap Toggle overflow 注記FIPS モードでは、

efikeygenが PKI データベース内でデフォルトの "NSS Certificate DB" トークンを検索できるように、--tokenオプションを使用する必要があります。公開鍵と秘密鍵は

/etc/pki/pesign/ディレクトリーに保存されます。

セキュリティー上、署名鍵の有効期間内にカーネルとカーネルモジュールに署名することが推奨されます。ただし、sign-file ユーティリティーは警告を表示せず、キーは有効期限に関係なく RHEL 8 で使用できます。

3.7. システムキーリングの出力例

keyutils パッケージからの keyctl ユーティリティーを使用して、システムのキーリングの鍵に関する情報を表示できます。

前提条件

- root 権限がある。

-

keyutilsパッケージからkeyctlユーティリティーをインストールしました。

例3.1 キーリング出力

以下は、UEFI セキュアブートが有効になっている RHEL 8 システムからの .builtin_trusted_keys、.platform、および .blacklist キーリングの短縮された出力例です。

この例の .builtin_trusted_keys キーリングは、UEFI セキュアブート db キーからの 2 つのキー、および shim ブートローダーに組み込まれている Red Hat Secure Boot (CA key 1) の追加を表しています。

例3.2 カーネルコンソール出力

以下の例は、カーネルコンソールの出力を示しています。このメッセージでは、UEFI セキュアブートに関連するソースの鍵を特定します。これらには、UEFI セキュアブート db、組み込みの shim、および MOK リストが含まれます。

3.8. 公開鍵を MOK リストに追加してターゲットシステムに公開鍵を登録する

カーネルまたはカーネルモジュールへのアクセスのために、システム上で公開鍵を認証し、それをターゲットシステムのプラットフォームキーリング (.platform) に登録する必要があります。セキュアブートが有効な UEFI ベースのシステムで RHEL 8 を起動すると、カーネルが db 鍵データベースから公開鍵をインポートし、dbx データベースから失効した鍵を除外します。

Machine Owner Key (MOK) 機能を使用すると、UEFI セキュアブートキーデータベースを拡張できます。セキュアブートが有効な UEFI 対応システムで RHEL 8 を起動すると、セキュアブートデータベースの鍵とともに、MOK リストの鍵がプラットフォームキーリング (.platform) に追加されます。MOK リストの鍵も、同じ方法でセキュアかつ永続的に保存されますが、これはセキュアブートデータベースとは別の機能です。

MOK 機能は、shim、MokManager、GRUB、および UEFI ベースのシステムでセキュアな鍵管理と認証を可能にする mokutil ユーティリティーによってサポートされています。

システムでカーネルモジュールの認証サービスを取得するには、ファクトリーファームウェアイメージで公開鍵を UEFI セキュアブート鍵データベースに組み入れるようシステムベンダーに要求することを検討してください。

前提条件

- 公開鍵と秘密鍵のペアを生成し、公開鍵の有効期限を知っています。詳細は、公開鍵と秘密鍵のペアの生成 を参照してください。

手順

公開鍵を

sb_cert.cerファイルにエクスポートします。certutil -d /etc/pki/pesign \ -n 'Custom Secure Boot key' \ -Lr \ > sb_cert.cer# certutil -d /etc/pki/pesign \ -n 'Custom Secure Boot key' \ -Lr \ > sb_cert.cerCopy to Clipboard Copied! Toggle word wrap Toggle overflow 公開鍵を MOK リストにインポートします。

mokutil --import sb_cert.cer

# mokutil --import sb_cert.cerCopy to Clipboard Copied! Toggle word wrap Toggle overflow - この MOK 登録要求の新しいパスワードを入力してください。

マシンを再起動します。

shimブートローダーは、保留中の MOK キー登録要求を認識し、MokManager.efiを起動して、UEFI コンソールから登録を完了できるようにします。Enroll MOKを選択し、プロンプトが表示されたら、この要求に関連付けたパスワードを入力し、登録を確認します。公開鍵が MOK リストに永続的に追加されます。

キーが MOK リストに追加されると、UEFI セキュアブートが有効になっている場合は、このブートおよび後続のブートで

.platformキーリングに自動的に伝達されます。

3.9. 秘密鍵でカーネルに署名する

UEFI セキュアブート機能が有効になっている場合は、署名済みカーネルをロードすると、システムのセキュリティーを強化できます。

前提条件

- 公開鍵と秘密鍵のペアを生成し、公開鍵の有効期限を知っています。詳細は、公開鍵と秘密鍵のペアの生成 を参照してください。

- ターゲットシステムに公開鍵を登録しています。詳細は、公開鍵を MOK リストに追加して、ターゲットシステムに公開鍵を登録する を参照してください。

- 署名に使用できる ELF 形式のカーネルイメージがあります。

手順

x64 アーキテクチャーの場合:

署名済みイメージを作成します。

pesign --certificate 'Custom Secure Boot key' \ --in vmlinuz-version \ --sign \ --out vmlinuz-version.signed# pesign --certificate 'Custom Secure Boot key' \ --in vmlinuz-version \ --sign \ --out vmlinuz-version.signedCopy to Clipboard Copied! Toggle word wrap Toggle overflow versionをvmlinuzファイルのバージョン接尾辞に置き換え、Custom Secure Boot keyを以前に選択した名前に置き換えます。オプション: 署名を確認します。

pesign --show-signature \ --in vmlinuz-version.signed# pesign --show-signature \ --in vmlinuz-version.signedCopy to Clipboard Copied! Toggle word wrap Toggle overflow 未署名イメージを署名済みイメージで上書きします。

mv vmlinuz-version.signed vmlinuz-version

# mv vmlinuz-version.signed vmlinuz-versionCopy to Clipboard Copied! Toggle word wrap Toggle overflow

64 ビット ARM アーキテクチャーの場合:

vmlinuzファイルを解凍します。zcat vmlinuz-version > vmlinux-version

# zcat vmlinuz-version > vmlinux-versionCopy to Clipboard Copied! Toggle word wrap Toggle overflow 署名済みイメージを作成します。

pesign --certificate 'Custom Secure Boot key' \ --in vmlinux-version \ --sign \ --out vmlinux-version.signed# pesign --certificate 'Custom Secure Boot key' \ --in vmlinux-version \ --sign \ --out vmlinux-version.signedCopy to Clipboard Copied! Toggle word wrap Toggle overflow オプション: 署名を確認します。

pesign --show-signature \ --in vmlinux-version.signed# pesign --show-signature \ --in vmlinux-version.signedCopy to Clipboard Copied! Toggle word wrap Toggle overflow vmlinuxファイルを圧縮します。gzip --to-stdout vmlinux-version.signed > vmlinuz-version

# gzip --to-stdout vmlinux-version.signed > vmlinuz-versionCopy to Clipboard Copied! Toggle word wrap Toggle overflow 圧縮されていない

vmlinuxファイルを削除します。rm vmlinux-version*

# rm vmlinux-version*Copy to Clipboard Copied! Toggle word wrap Toggle overflow

3.10. 秘密鍵で GRUB ビルドに署名する

UEFI セキュアブート機能が有効になっているシステムでは、カスタムの既存の秘密鍵で GRUB ビルドに署名できます。カスタム GRUB ビルドを使用している場合、またはシステムから Microsoft トラストアンカーを削除した場合は、これを行う必要があります。

前提条件

- 公開鍵と秘密鍵のペアを生成し、公開鍵の有効期限を知っています。詳細は、公開鍵と秘密鍵のペアの生成 を参照してください。

- ターゲットシステムに公開鍵を登録しています。詳細は、公開鍵を MOK リストに追加して、ターゲットシステムに公開鍵を登録する を参照してください。

- 署名に使用できる GRUB EFI バイナリーがあります。

手順

x64 アーキテクチャーの場合:

署名済み GRUB EFI バイナリーを作成します。

pesign --in /boot/efi/EFI/redhat/grubx64.efi \ --out /boot/efi/EFI/redhat/grubx64.efi.signed \ --certificate 'Custom Secure Boot key' \ --sign# pesign --in /boot/efi/EFI/redhat/grubx64.efi \ --out /boot/efi/EFI/redhat/grubx64.efi.signed \ --certificate 'Custom Secure Boot key' \ --signCopy to Clipboard Copied! Toggle word wrap Toggle overflow Custom Secure Boot keyを以前に選択した名前に置き換えます。オプション: 署名を確認します。

pesign --in /boot/efi/EFI/redhat/grubx64.efi.signed \ --show-signature# pesign --in /boot/efi/EFI/redhat/grubx64.efi.signed \ --show-signatureCopy to Clipboard Copied! Toggle word wrap Toggle overflow 署名されていないバイナリーを署名済みバイナリーで上書きします。

mv /boot/efi/EFI/redhat/grubx64.efi.signed \ /boot/efi/EFI/redhat/grubx64.efi# mv /boot/efi/EFI/redhat/grubx64.efi.signed \ /boot/efi/EFI/redhat/grubx64.efiCopy to Clipboard Copied! Toggle word wrap Toggle overflow

64 ビット ARM アーキテクチャーの場合:

署名済み GRUB EFI バイナリーを作成します。

pesign --in /boot/efi/EFI/redhat/grubaa64.efi \ --out /boot/efi/EFI/redhat/grubaa64.efi.signed \ --certificate 'Custom Secure Boot key' \ --sign# pesign --in /boot/efi/EFI/redhat/grubaa64.efi \ --out /boot/efi/EFI/redhat/grubaa64.efi.signed \ --certificate 'Custom Secure Boot key' \ --signCopy to Clipboard Copied! Toggle word wrap Toggle overflow Custom Secure Boot keyを以前に選択した名前に置き換えます。オプション: 署名を確認します。

pesign --in /boot/efi/EFI/redhat/grubaa64.efi.signed \ --show-signature# pesign --in /boot/efi/EFI/redhat/grubaa64.efi.signed \ --show-signatureCopy to Clipboard Copied! Toggle word wrap Toggle overflow 署名されていないバイナリーを署名済みバイナリーで上書きします。

mv /boot/efi/EFI/redhat/grubaa64.efi.signed \ /boot/efi/EFI/redhat/grubaa64.efi# mv /boot/efi/EFI/redhat/grubaa64.efi.signed \ /boot/efi/EFI/redhat/grubaa64.efiCopy to Clipboard Copied! Toggle word wrap Toggle overflow

3.11. 秘密鍵を使用したカーネルモジュールの署名

UEFI セキュアブートメカニズムが有効になっている場合は、署名済みカーネルモジュールをロードすることでシステムのセキュリティーを強化できます。

署名済みカーネルモジュールは、UEFI セキュアブートが無効になっているシステムまたは非 UEFI システムでもロードできます。そのため、カーネルモジュールの署名済みバージョンと未署名バージョンの両方を提供する必要はありません。

前提条件

- 公開鍵と秘密鍵のペアを生成し、公開鍵の有効期限を知っています。詳細は、公開鍵と秘密鍵のペアの生成 を参照してください。

- ターゲットシステムに公開鍵を登録しています。詳細は、公開鍵を MOK リストに追加して、ターゲットシステムに公開鍵を登録する を参照してください。

- ELF イメージ形式で署名できるカーネルモジュールがある。

手順

公開鍵を

sb_cert.cerファイルにエクスポートします。certutil -d /etc/pki/pesign \ -n 'Custom Secure Boot key' \ -Lr \ > sb_cert.cer# certutil -d /etc/pki/pesign \ -n 'Custom Secure Boot key' \ -Lr \ > sb_cert.cerCopy to Clipboard Copied! Toggle word wrap Toggle overflow NSS データベースからキーを PKCS #12 ファイルとして抽出します。

pk12util -o sb_cert.p12 \ -n 'Custom Secure Boot key' \ -d /etc/pki/pesign# pk12util -o sb_cert.p12 \ -n 'Custom Secure Boot key' \ -d /etc/pki/pesignCopy to Clipboard Copied! Toggle word wrap Toggle overflow - 前のコマンドのプロンプトが表示されたら、秘密鍵を暗号化する新しいパスワードを入力します。

暗号化されていない秘密鍵をエクスポートします。

openssl pkcs12 \ -in sb_cert.p12 \ -out sb_cert.priv \ -nocerts \ -nodes# openssl pkcs12 \ -in sb_cert.p12 \ -out sb_cert.priv \ -nocerts \ -nodesCopy to Clipboard Copied! Toggle word wrap Toggle overflow 重要暗号化されていない秘密鍵を安全に保管してください。

カーネルモジュールに署名します。次のコマンドは、カーネルモジュールファイル内の ELF イメージに署名を直接追加します。

/usr/src/kernels/$(uname -r)/scripts/sign-file \ sha256 \ sb_cert.priv \ sb_cert.cer \ my_module.ko# /usr/src/kernels/$(uname -r)/scripts/sign-file \ sha256 \ sb_cert.priv \ sb_cert.cer \ my_module.koCopy to Clipboard Copied! Toggle word wrap Toggle overflow

これでカーネルモジュールの読み込み準備が完了しました。

RHEL 8 では、キーペアの有効期限が重要です。鍵に有効期限はありませんが、カーネルモジュールはその署名鍵の有効期間内に署名する必要があります。sign-file ユーティリティーでは、これに関する警告は表示されません。たとえば、2019 でのみ有効な鍵を使用して、その鍵で 2019 で署名されたカーネルモジュールを認証できます。ただし、ユーザーはこの鍵を使用して 2020 でカーネルモジュールに署名することはできません。

検証

カーネルモジュールの署名に関する情報を表示します。

modinfo my_module.ko | grep signer

# modinfo my_module.ko | grep signer signer: Your Name KeyCopy to Clipboard Copied! Toggle word wrap Toggle overflow 生成時に入力した名前が署名に記載されていることを確認します。

注記この追加された署名は ELF イメージセクションには含まれず、また ELF イメージの正式な一部ではありません。したがって、

readelfなどのユーティリティーは、カーネルモジュールの署名を表示できません。モジュールをロードします。

insmod my_module.ko

# insmod my_module.koCopy to Clipboard Copied! Toggle word wrap Toggle overflow モジュールを削除 (アンロード) します。

modprobe -r my_module.ko

# modprobe -r my_module.koCopy to Clipboard Copied! Toggle word wrap Toggle overflow

3.12. 署名済みカーネルモジュールの読み込み

公開鍵をシステムキーリング (.builtin_trusted_keys) と MOK リストに登録し、秘密鍵でカーネルモジュールに署名したら、modprobe コマンドを使用してそれらをロードできます。

前提条件

- 公開鍵と秘密鍵のペアを生成した。詳細は、公開鍵と秘密鍵のペアの生成 を参照してください。

- 公開鍵をシステムのキーリングに登録している。詳細は、公開鍵を MOK リストに追加して、ターゲットシステムに公開鍵を登録する を参照してください。

- 秘密鍵でカーネルモジュールに署名している。詳細は、秘密鍵を使用したカーネルモジュールの署名 を参照してください。

/lib/modules/$(uname -r)/extra/ディレクトリーを作成するkernel-modules-extraパッケージをインストールします。yum -y install kernel-modules-extra

# yum -y install kernel-modules-extraCopy to Clipboard Copied! Toggle word wrap Toggle overflow

手順

公開鍵がシステムキーリング上にあることを確認します。

keyctl list %:.platform

# keyctl list %:.platformCopy to Clipboard Copied! Toggle word wrap Toggle overflow カーネルモジュールを必要なカーネルの

extra/ディレクトリーにコピーします。cp my_module.ko /lib/modules/$(uname -r)/extra/

# cp my_module.ko /lib/modules/$(uname -r)/extra/Copy to Clipboard Copied! Toggle word wrap Toggle overflow モジュールの依存関係のリストを更新します。

depmod -a

# depmod -aCopy to Clipboard Copied! Toggle word wrap Toggle overflow カーネルモジュールを読み込みます。

modprobe -v my_module

# modprobe -v my_moduleCopy to Clipboard Copied! Toggle word wrap Toggle overflow オプション: 起動時にモジュールをロードするには、

/etc/modules-loaded.d/my_module.confファイルに追加します。echo "my_module" > /etc/modules-load.d/my_module.conf

# echo "my_module" > /etc/modules-load.d/my_module.confCopy to Clipboard Copied! Toggle word wrap Toggle overflow

検証

モジュールが正常にロードされたことを確認します。

lsmod | grep my_module

# lsmod | grep my_moduleCopy to Clipboard Copied! Toggle word wrap Toggle overflow

第4章 カーネルコマンドラインパラメーターの設定

カーネルコマンドラインパラメーターを使用すると、起動時に Red Hat Enterprise Linux カーネルの特定の側面の動作を変更できます。システム管理者は、起動時に設定されるオプションを制御します。特定のカーネル動作は起動時にのみ設定できることに注意してください。

カーネルコマンドラインパラメーターを変更してシステムの動作を変更すると、システムに悪影響を及ぼす可能性があります。変更を実稼働環境にデプロイする前に必ずテストしてください。詳細なガイダンスは、Red Hat Support チームまでご連絡ください。

4.1. カーネルコマンドラインパラメーターとは

カーネルコマンドラインパラメーターを使用すると、デフォルト値を上書きしたり、特定のハードウェア設定を指定したりできます。ブート時に、次の機能を設定できます。

- Red Hat Enterprise Linux カーネル

- 初期 RAM ディスク

- ユーザー領域機能

デフォルトでは、GRUB ブートローダーを使用するシステムのカーネルコマンドラインパラメーターは、カーネルブートエントリーごとに /boot/grub2/grubenv ファイルの kernelopts 変数で定義されます。

IBM Z では、zipl ブートローダーは環境変数に対応していないため、カーネルコマンドラインパラメーターはブートエントリー設定ファイルに保存されます。したがって、kernelopts 環境変数は使用できません。

grubby ユーティリティーを使用すると、ブートローダー設定ファイルを操作できます。grubby を使用すると、次のアクションを実行できます。

- デフォルトのブートエントリーの変更

- GRUB メニューエントリーに対する引数の追加または削除

4.2. ブートエントリーについて

ブートエントリーは、設定ファイルに保存され、特定のカーネルバージョンに関連付けられたオプションのコレクションです。実際には、ブートエントリーは、システムにカーネルがインストールされているのと同じ数だけあります。ブートエントリー設定ファイルは、/boot/loader/entries/ ディレクトリーにあります。

6f9cc9cb7d7845d49698c9537337cedc-4.18.0-5.el8.x86_64.conf

6f9cc9cb7d7845d49698c9537337cedc-4.18.0-5.el8.x86_64.conf

上記のファイル名は、/etc/machine-id ファイルに保存されているマシン ID と、カーネルバージョンから構成されます。

ブートエントリー設定ファイルには、カーネルバージョン、初期 ramdisk イメージ、およびカーネルのコマンドラインパラメーターを含む kernelopts 環境変数に関する情報が含まれています。設定ファイルには次の内容を含めることができます。

kernelopts 環境変数は /boot/grub2/grubenv ファイルで定義されます。

4.3. すべてのブートエントリーでカーネルコマンドラインパラメーターの変更

システム上のすべてのブートエントリーのカーネルコマンドラインパラメーターを変更します。

前提条件

-

grubbyユーティリティーがシステムにインストールされている。 -

ziplユーティリティーが IBM Z システムにインストールされている。

手順

パラメーターを追加するには、以下を行います。

grubby --update-kernel=ALL --args="<NEW_PARAMETER>"

# grubby --update-kernel=ALL --args="<NEW_PARAMETER>"Copy to Clipboard Copied! Toggle word wrap Toggle overflow GRUB ブートローダーを使用するシステムの場合は、

/boot/grub2/grubenvのkernelopts変数に新しいカーネルパラメーターを追加して、ファイルを更新します。IBM Z で、ブートメニューを更新します。

zipl

# ziplCopy to Clipboard Copied! Toggle word wrap Toggle overflow

パラメーターを削除するには、次のコマンドを実行します。

grubby --update-kernel=ALL --remove-args="<PARAMETER_TO_REMOVE>"

# grubby --update-kernel=ALL --remove-args="<PARAMETER_TO_REMOVE>"Copy to Clipboard Copied! Toggle word wrap Toggle overflow IBM Z で、ブートメニューを更新します。

zipl

# ziplCopy to Clipboard Copied! Toggle word wrap Toggle overflow

新しくインストールされたカーネルは、以前に設定されたカーネルからカーネルコマンドラインパラメーターを継承します。

4.4. 1 つのブートエントリーでカーネルコマンドラインパラメーターの変更

システム上の単一のブートエントリーのカーネルコマンドラインパラメーターを変更します。

前提条件

-

grubbyおよびziplユーティリティーがシステムにインストールされている。

手順

パラメーターを追加するには、以下を行います。

grubby --update-kernel=/boot/vmlinuz-$(uname -r) --args="<NEW_PARAMETER>"

# grubby --update-kernel=/boot/vmlinuz-$(uname -r) --args="<NEW_PARAMETER>"Copy to Clipboard Copied! Toggle word wrap Toggle overflow IBM Z で、ブートメニューを更新します。

grubby --args="<NEW_PARAMETER> --update-kernel=ALL --zipl

# grubby --args="<NEW_PARAMETER> --update-kernel=ALL --ziplCopy to Clipboard Copied! Toggle word wrap Toggle overflow

パラメーターを削除するには、次のコマンドを実行します。

grubby --update-kernel=/boot/vmlinuz-$(uname -r) --remove-args="<PARAMETER_TO_REMOVE>"

# grubby --update-kernel=/boot/vmlinuz-$(uname -r) --remove-args="<PARAMETER_TO_REMOVE>"Copy to Clipboard Copied! Toggle word wrap Toggle overflow IBM Z で、ブートメニューを更新します。

grubby --args="<PARAMETER_TO_REMOVE> --update-kernel=ALL --zipl

# grubby --args="<PARAMETER_TO_REMOVE> --update-kernel=ALL --ziplCopy to Clipboard Copied! Toggle word wrap Toggle overflow

grub.cfg ファイルを使用するシステムでは、デフォルトで、カーネルブートエントリーごとに options パラメーターがあり、これは kernelopts 変数に設定されます。この変数は、/boot/grub2/grubenv 設定ファイルで定義されます。

GRUB システムの場合:

-

すべてのブートエントリーに対してカーネルコマンドラインパラメーターを変更する場合には、

grubbyユーティリティーは/boot/grub2/grubenvファイルのkernelopts変数を更新します。 -

1 つのブートエントリーのカーネルコマンドラインパラメーターが変更されると、

kernelopts変数の拡張やカーネルパラメーターの変更が行われ、得られた値は各ブートエントリーの/boot/loader/entries/<RELEVANT_KERNEL_BOOT_ENTRY.conf>ファイルに保存されます。

zIPL システムの場合:

-

grubbyは、個別のカーネルブートエントリーのカーネルコマンドラインパラメーターを変更して、/boot/loader/entries/<ENTRY>.confファイルに保存します。

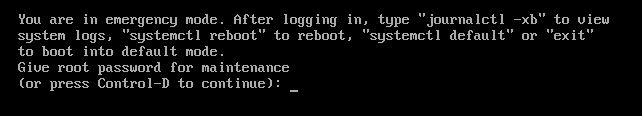

4.5. 起動時の一時的なカーネルコマンドラインパラメーターの変更

1 回の起動プロセス中にのみカーネルパラメーターを変更することで、カーネルメニューエントリーを一時的に変更します。

この手順は単一ブートにのみ適用され、変更は永続的に行われません。

手順

- GRUB ブートメニューを起動します。

- 起動するカーネルを選択します。

- e キーを押してカーネルパラメーターを編集します。

-

カーソルを下に移動してカーネルコマンドラインを見つけます。カーネルコマンドラインは、64 ビット IBM Power シリーズおよび x86-64 BIOS ベースのシステムの場合は

linuxで始まり、UEFI システムの場合はlinuxefiで始まります。 カーソルを行の最後に移動します。

注記行の最初に移動するには Ctrl+a を押します。行の最後に移動するには Ctrl+e を押します。システムによっては、Home キーおよび End キーも機能する場合があります。

必要に応じてカーネルパラメーターを編集します。たとえば、緊急モードでシステムを実行するには、

linux行の最後にemergencyパラメーターを追加します。linux ($root)/vmlinuz-4.18.0-348.12.2.el8_5.x86_64 root=/dev/mapper/rhel-root ro crashkernel=auto resume=/dev/mapper/rhel-swap rd.lvm.lv=rhel/root rd.lvm.lv=rhel/swap rhgb quiet emergency

linux ($root)/vmlinuz-4.18.0-348.12.2.el8_5.x86_64 root=/dev/mapper/rhel-root ro crashkernel=auto resume=/dev/mapper/rhel-swap rd.lvm.lv=rhel/root rd.lvm.lv=rhel/swap rhgb quiet emergencyCopy to Clipboard Copied! Toggle word wrap Toggle overflow システムメッセージを有効にするには、

rhgbおよびquietパラメーターを削除します。- Ctrl+x を押して、選択したカーネルと変更したコマンドラインパラメーターで起動します。

Esc キーを押してコマンドラインの編集を終了すると、ユーザーの加えた変更はすべて破棄されます。

4.6. シリアルコンソール接続を有効にする GRUB 設定

シリアルコンソールは、ネットワークがダウンしている場合にヘッドレスサーバーまたは埋め込みシステムに接続する際に便利です。あるいは、セキュリティールールを回避し、別のシステムへのログインアクセスを取得する必要がある場合などです。

シリアルコンソール接続を使用するように、デフォルトの GRUB 設定の一部を設定する必要があります。

前提条件

- root 権限がある。

手順

/etc/default/grubファイルに以下の 2 つの行を追加します。GRUB_TERMINAL="serial" GRUB_SERIAL_COMMAND="serial --speed=9600 --unit=0 --word=8 --parity=no --stop=1"

GRUB_TERMINAL="serial" GRUB_SERIAL_COMMAND="serial --speed=9600 --unit=0 --word=8 --parity=no --stop=1"Copy to Clipboard Copied! Toggle word wrap Toggle overflow 最初の行は、グラフィカルターミナルを無効にします。

GRUB_TERMINALキーは、GRUB_TERMINAL_INPUTおよびGRUB_TERMINAL_OUTPUTの値を上書きします。2 行目は、ボーレート (

--speed)、パリティー、および他の値を使用中の環境とハードウェアに適合するように調整します。以下のログファイルのようなタスクには、115200 のように非常に高いボーレートが推奨されます。GRUB 設定ファイルを更新します。

BIOS ベースのマシンの場合:

grub2-mkconfig -o /boot/grub2/grub.cfg

# grub2-mkconfig -o /boot/grub2/grub.cfgCopy to Clipboard Copied! Toggle word wrap Toggle overflow UEFI ベースのマシンの場合:

grub2-mkconfig -o /boot/efi/EFI/redhat/grub.cfg

# grub2-mkconfig -o /boot/efi/EFI/redhat/grub.cfgCopy to Clipboard Copied! Toggle word wrap Toggle overflow

- システムを再起動して、変更を有効にします。

第5章 実行時のカーネルパラメーターの設定

システム管理者は、実行時に Red Hat Enterprise Linux カーネルの動作のさまざまな側面を変更できます。sysctl コマンドを使用し、/etc/sysctl.d/ および /proc/sys/ ディレクトリー内の設定ファイルを変更して、実行時にカーネルパラメーターを設定します。

プロダクションシステムでカーネルパラメーターを設定するには、慎重なプランニングが必要です。計画外の変更を行うと、カーネルが不安定になり、システムの再起動が必要になる場合があります。カーネル値を変更する前に、有効なオプションを使用していることを確認してください。

IBM DB2 でのカーネルのチューニングに関する詳細は、Tuning Red Hat Enterprise Linux for IBM DB2 を参照してください。

5.1. カーネルパラメーターとは

カーネルパラメーターは、システムの実行中に調整できる調整可能な値です。変更を有効にするために、システムを再起動したりカーネルを再コンパイルしたりする必要がないことに注意してください。

以下を使用してカーネルパラメーターに対応できます。

-

sysctlコマンド -

/proc/sys/ディレクトリーにマウントされている仮想ファイルシステム -

/etc/sysctl.d/ディレクトリー内の設定ファイル

調整可能パラメーターは、カーネルサブシステムでクラスに分割されます。Red Hat Enterprise Linux には、以下の調整可能のクラスがあります。

| 調整パラメーターのクラス | サブシステム |

|---|---|

|

| 実行ドメインおよびパーソナリティー |

|

| 暗号化インターフェイス |

|

| カーネルのデバッグインターフェイス |

|

| デバイス固有の情報 |

|

| グローバルおよび特定のファイルシステムの設定項目 |

|

| グローバルなカーネルの設定項目 |

|

| ネットワークの設定項目 |

|

| Sun Remote Procedure Call (NFS) |

|

| ユーザー名前空間の制限 |

|

| メモリー、バッファー、およびキャッシュのチューニングと管理 |

5.2. sysctl でカーネルパラメーターの一時的な設定

sysctl コマンドを使用して、実行時に一時的にカーネルパラメーターを設定します。このコマンドは、調整可能パラメーターのリスト表示およびフィルタリングにも便利です。

前提条件

- root 権限がある。

手順

すべてのパラメーターとその値をリストします。

sysctl -a

# sysctl -a# sysctl -aCopy to Clipboard Copied! Toggle word wrap Toggle overflow 注記# sysctl -aコマンドは、ランタイム時およびシステムの起動時に調整できるカーネルパラメーターを表示します。パラメーターを一時的に設定するには、次のように入力します。

sysctl <TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE>

# sysctl <TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE>Copy to Clipboard Copied! Toggle word wrap Toggle overflow 上記のサンプルコマンドは、システムの実行中にパラメーター値を変更します。この変更は、再起動なしですぐに適用されます。

注記変更は、システムの再起動後にデフォルトに戻ります。

5.3. sysctl を使用したカーネルパラメーターの永続的な設定

sysctl コマンドを使用して、カーネルパラメーターを永続的に設定します。

前提条件

- root 権限がある。

手順

すべてのパラメーターをリストします。

sysctl -a

# sysctl -a# sysctl -aCopy to Clipboard Copied! Toggle word wrap Toggle overflow このコマンドは、実行時に設定できるカーネルパラメーターをすべて表示します。

パラメーターを永続的に設定します。

sysctl -w <TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE> >> /etc/sysctl.conf

# sysctl -w <TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE> >> /etc/sysctl.confCopy to Clipboard Copied! Toggle word wrap Toggle overflow サンプルコマンドは、調整可能な値を変更して、

/etc/sysctl.confファイルに書き込みます。これにより、カーネルパラメーターのデフォルト値が上書きされます。変更は、再起動なしで即座に永続的に反映されます。

カーネルパラメーターを永続的に変更するには、/etc/sysctl.d/ ディレクトリーの設定ファイルを手動で変更することもできます。

5.4. /etc/sysctl.d/ の設定ファイルでカーネルパラメーターの調整

カーネルパラメーターを永続的に設定するには、/etc/sysctl.d/ ディレクトリー内の設定ファイルを手動で変更する必要があります。

前提条件

- root 権限がある。

手順

/etc/sysctl.d/に新しい設定ファイルを作成します。vim /etc/sysctl.d/<some_file.conf>

# vim /etc/sysctl.d/<some_file.conf># vim /etc/sysctl.d/<some_file.conf>Copy to Clipboard Copied! Toggle word wrap Toggle overflow カーネルパラメーターを 1 行に 1 つずつ含めます。

<TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE> <TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE>

<TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE> <TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE><TUNABLE_CLASS>.<PARAMETER>=<TARGET_VALUE>Copy to Clipboard Copied! Toggle word wrap Toggle overflow - 設定ファイルを保存します。

マシンを再起動して、変更を有効にします。

または、再起動せずに変更を適用します。

sysctl -p /etc/sysctl.d/<some_file.conf>

# sysctl -p /etc/sysctl.d/<some_file.conf># sysctl -p /etc/sysctl.d/<some_file.conf>Copy to Clipboard Copied! Toggle word wrap Toggle overflow このコマンドにより、以前に作成した設定ファイルから値を読み取ることができます。

5.5. /proc/sys/ でカーネルパラメーターの一時的な設定

/proc/sys/ 仮想ファイルシステムディレクトリー内のファイルを使用して、一時的にカーネルパラメーターを設定します。

前提条件

- root 権限がある。

手順

設定するカーネルパラメーターを特定します。

ls -l /proc/sys/<TUNABLE_CLASS>/

# ls -l /proc/sys/<TUNABLE_CLASS>/# ls -l /proc/sys/<TUNABLE_CLASS>/Copy to Clipboard Copied! Toggle word wrap Toggle overflow コマンドが返した書き込み可能なファイルは、カーネルの設定に使用できます。読み取り専用権限を持つファイルは、現在の設定に関するフィードバックを提供します。

カーネルパラメーターにターゲットの値を割り当てます。

echo <TARGET_VALUE> > /proc/sys/<TUNABLE_CLASS>/<PARAMETER>

# echo <TARGET_VALUE> > /proc/sys/<TUNABLE_CLASS>/<PARAMETER># echo <TARGET_VALUE> > /proc/sys/<TUNABLE_CLASS>/<PARAMETER>Copy to Clipboard Copied! Toggle word wrap Toggle overflow コマンドを使用して適用された設定の変更は永続的なものではなく、システムを再起動すると消えてしまいます。

検証

新しく設定したカーネルパラメーターの値を確認します。

cat /proc/sys/<TUNABLE_CLASS>/<PARAMETER>

# cat /proc/sys/<TUNABLE_CLASS>/<PARAMETER># cat /proc/sys/<TUNABLE_CLASS>/<PARAMETER>Copy to Clipboard Copied! Toggle word wrap Toggle overflow

第7章 GRUB ブートローダーに永続的な変更を加える

grubby ツールを使用して、GRUB で永続的な変更を行います。

7.1. 前提条件

- システムに RHEL が正常にインストールされました。

- root 権限がある。

7.2. デフォルトのカーネルの一覧表示

デフォルトのカーネルを一覧表示すると、デフォルトのカーネルのファイル名およびインデックス番号を見つけて、GRUB ブートローダーに永続的な変更を加えることができます。

手順

- デフォルトカーネルのファイル名を取得するには、次のように入力します。

grubby --default-kernel

# grubby --default-kernel

/boot/vmlinuz-4.18.0-372.9.1.el8.x86_64- デフォルトカーネルのインデックス番号を取得するには、次のように入力します。

grubby --default-index

# grubby --default-index

07.4. カーネル引数の編集

既存のカーネル引数の値を変更できます。たとえば、仮想コンソール (画面) のフォントとサイズを変更できます。

手順

仮想コンソールのフォントを、サイズが

32のlatarcyrheb-sunに変更します。grubby --args=vconsole.font=latarcyrheb-sun32 --update-kernel /boot/vmlinuz-4.18.0-372.9.1.el8.x86_64

# grubby --args=vconsole.font=latarcyrheb-sun32 --update-kernel /boot/vmlinuz-4.18.0-372.9.1.el8.x86_64Copy to Clipboard Copied! Toggle word wrap Toggle overflow

7.6. 新しいブートエントリーの追加

ブートローダーメニューエントリーに新しいブートエントリーを追加できます。

手順

すべてのカーネル引数をデフォルトカーネルからこの新しいカーネルエントリーにコピーします。

grubby --add-kernel=new_kernel --title="entry_title" --initrd="new_initrd" --copy-default

# grubby --add-kernel=new_kernel --title="entry_title" --initrd="new_initrd" --copy-defaultCopy to Clipboard Copied! Toggle word wrap Toggle overflow 利用可能なブートエントリーのリストを取得します。

ls -l /boot/loader/entries/*

# ls -l /boot/loader/entries/* -rw-r--r--. 1 root root 408 May 27 06:18 /boot/loader/entries/67db13ba8cdb420794ef3ee0a8313205-0-rescue.conf -rw-r--r--. 1 root root 536 Jun 30 07:53 /boot/loader/entries/67db13ba8cdb420794ef3ee0a8313205-4.18.0-372.9.1.el8.x86_64.conf -rw-r--r-- 1 root root 336 Aug 15 15:12 /boot/loader/entries/d88fa2c7ff574ae782ec8c4288de4e85-4.18.0-193.el8.x86_64.confCopy to Clipboard Copied! Toggle word wrap Toggle overflow 新たなブートエントリーを作成します。たとえば、4.18.0-193.el8.x86_64 カーネルの場合は、次のようにコマンドを発行します。

grubby --grub2 --add-kernel=/boot/vmlinuz-4.18.0-193.el8.x86_64 --title="Red Hat Enterprise 8 Test" --initrd=/boot/initramfs-4.18.0-193.el8.x86_64.img --copy-default

# grubby --grub2 --add-kernel=/boot/vmlinuz-4.18.0-193.el8.x86_64 --title="Red Hat Enterprise 8 Test" --initrd=/boot/initramfs-4.18.0-193.el8.x86_64.img --copy-defaultCopy to Clipboard Copied! Toggle word wrap Toggle overflow

検証

新しく追加されたブートエントリーが、使用可能なブートエントリーのリストに表示されていることを確認します。

ls -l /boot/loader/entries/*

# ls -l /boot/loader/entries/* -rw-r--r--. 1 root root 408 May 27 06:18 /boot/loader/entries/67db13ba8cdb420794ef3ee0a8313205-0-rescue.conf -rw-r--r--. 1 root root 536 Jun 30 07:53 /boot/loader/entries/67db13ba8cdb420794ef3ee0a8313205-4.18.0-372.9.1.el8.x86_64.conf -rw-r--r-- 1 root root 287 Aug 16 15:17 /boot/loader/entries/d88fa2c7ff574ae782ec8c4288de4e85-4.18.0-193.el8.x86_64.0~custom.conf -rw-r--r-- 1 root root 287 Aug 16 15:29 /boot/loader/entries/d88fa2c7ff574ae782ec8c4288de4e85-4.18.0-193.el8.x86_64.confCopy to Clipboard Copied! Toggle word wrap Toggle overflow

7.7. grubby でデフォルトのブートエントリーを変更する

grubby ツールを使用すると、デフォルトのブートエントリーを変更できます。

手順

- デフォルトのカーネルとして指定されたカーネルに永続的な変更を加えるには、次のように入力します。

grubby --set-default /boot/vmlinuz-4.18.0-372.9.1.el8.x86_64

# grubby --set-default /boot/vmlinuz-4.18.0-372.9.1.el8.x86_64

The default is /boot/loader/entries/67db13ba8cdb420794ef3ee0a8313205-4.18.0-372.9.1.el8.x86_64.conf with index 0 and kernel /boot/vmlinuz-4.18.0-372.9.1.el8.x86_647.9. 現在および将来のカーネルのデフォルトカーネルオプションの変更

kernelopts 変数を使用すると、現在および将来のカーネルのデフォルトカーネルオプションを変更できます。

手順

kernelopts変数を使用してカーネルパラメーターをリスト表示します。grub2-editenv - list | grep kernelopts

# grub2-editenv - list | grep kernelopts kernelopts=root=/dev/mapper/rhel-root ro crashkernel=auto resume=/dev/mapper/rhel-swap rd.lvm.lv=rhel/root rd.lvm.lv=rhel/swap rhgb quietCopy to Clipboard Copied! Toggle word wrap Toggle overflow カーネルのコマンドラインパラメーターを変更します。パラメーターを追加、削除、または変更できます。たとえば、

debugパラメーターを追加するには、次のように入力します。grub2-editenv - set "$(grub2-editenv - list | grep kernelopts) <debug>"

# grub2-editenv - set "$(grub2-editenv - list | grep kernelopts) <debug>"Copy to Clipboard Copied! Toggle word wrap Toggle overflow オプション:

kerneloptsに新しく追加されたパラメーターを確認します。grub2-editenv - list | grep kernelopts

# grub2-editenv - list | grep kernelopts kernelopts=root=/dev/mapper/rhel-root ro crashkernel=auto resume=/dev/mapper/rhel-swap rd.lvm.lv=rhel/root rd.lvm.lv=rhel/swap rhgb quiet debugCopy to Clipboard Copied! Toggle word wrap Toggle overflow - システムを再起動して、変更を有効にします。

代わりに、grubby コマンドを使用して、現在および将来のカーネルに引数を渡すこともできます。

grubby --update-kernel ALL --args="<PARAMETER>"

# grubby --update-kernel ALL --args="<PARAMETER>"第9章 GRUB の再インストール

GRUB ブートローダーを再インストールすると、GRUB の誤ったインストール、ファイルの欠落、またはシステムの破損によってよく発生する一部の問題を修正できます。これらの問題は、不足しているファイルを復元し、ブート情報を更新することで解決できます。

GRUB を再インストールする理由:

- GRUB ブートローダーパッケージをアップグレードする。

- 別のドライブにブート情報を追加する。

- インストール済みのオペレーティングシステムを制御するために、ユーザーが GRUB ブートローダーを必要としている。ただし、一部のオペレーティングシステムには独自のブートローダーがインストールされており、GRUB を再インストールすると、目的のオペレーティングシステムに制御権限が戻されます。

GRUB は、ファイルが破損していない場合にのみファイルを復元します。

9.1. BIOS ベースマシンへの GRUB の再インストール

BIOS ベースのシステムに GRUB ブートローダーを再インストールできます。GRUB パッケージを更新した後は必ず GRUB を再インストールしてください。

これにより、既存の GRUB が上書きされ、新しい GRUB がインストールされます。インストール中にシステムでデータの破損やブートクラッシュが発生しないようにしてください。

手順

GRUB がインストールされているデバイスに GRUB を再インストールします。たとえば、

sdaがデバイスの場合は、以下のようになります。grub2-install /dev/sda

# grub2-install /dev/sdaCopy to Clipboard Copied! Toggle word wrap Toggle overflow システムを再起動して、変更を有効にします。

reboot

# rebootCopy to Clipboard Copied! Toggle word wrap Toggle overflow

9.2. UEFI ベースマシンへの GRUB の再インストール

UEFI ベースのシステムに GRUB ブートローダーを再インストールできます。

インストール中にシステムでデータの破損やブートクラッシュが発生しないようにしてください。

手順

grub2-efiおよびshimブートローダーファイルを再インストールします。yum reinstall grub2-efi shim

# yum reinstall grub2-efi shimCopy to Clipboard Copied! Toggle word wrap Toggle overflow システムを再起動して、変更を有効にします。

reboot

# rebootCopy to Clipboard Copied! Toggle word wrap Toggle overflow

9.3. IBM Power マシンへの GRUB の再インストール

IBM Power システムの Power PC Reference Platform (PReP) ブートパーティションに GRUB ブートローダーを再インストールできます。GRUB パッケージを更新した後は必ず GRUB を再インストールしてください。

これにより、既存の GRUB が上書きされ、新しい GRUB がインストールされます。インストール中にシステムでデータの破損やブートクラッシュが発生しないようにしてください。

手順

GRUB が格納されているディスクパーティションを特定します。

bootlist -m normal -o

# bootlist -m normal -o sda1Copy to Clipboard Copied! Toggle word wrap Toggle overflow ディスクパーティションに GRUB を再インストールします。

grub2-install partition

# grub2-install partitionCopy to Clipboard Copied! Toggle word wrap Toggle overflow partitionは、識別された GRUB パーティション (/dev/sda1など) に置き換えます。システムを再起動して、変更を有効にします。

reboot

# rebootCopy to Clipboard Copied! Toggle word wrap Toggle overflow

9.4. GRUB のリセット

GRUB をリセットすると、すべての GRUB 設定ファイルとシステム設定が完全に削除され、ブートローダーが再インストールされます。すべての設定をデフォルト値にリセットして、破損したファイルや無効な設定によって発生した障害を修正できます。

次の手順では、ユーザーが行ったすべてのカスタマイズが削除されます。

手順

設定ファイルを削除します。

rm /etc/grub.d/* rm /etc/sysconfig/grub

# rm /etc/grub.d/* # rm /etc/sysconfig/grubCopy to Clipboard Copied! Toggle word wrap Toggle overflow パッケージを再インストールします。

BIOS ベースのマシンの場合:

yum reinstall grub2-tools

# yum reinstall grub2-toolsCopy to Clipboard Copied! Toggle word wrap Toggle overflow UEFI ベースのマシンの場合:

yum reinstall grub2-efi shim grub2-tools grub2-common

# yum reinstall grub2-efi shim grub2-tools grub2-commonCopy to Clipboard Copied! Toggle word wrap Toggle overflow

変更を有効にするために

grub.cfgファイルを再ビルドします。BIOS ベースのマシンの場合:

grub2-mkconfig -o /boot/grub2/grub.cfg

# grub2-mkconfig -o /boot/grub2/grub.cfgCopy to Clipboard Copied! Toggle word wrap Toggle overflow UEFI ベースのマシンの場合:

grub2-mkconfig -o /boot/efi/EFI/redhat/grub.cfg

# grub2-mkconfig -o /boot/efi/EFI/redhat/grub.cfgCopy to Clipboard Copied! Toggle word wrap Toggle overflow

-

GRUB の再インストール 手順に従って、

/boot/パーティションに GRUB を復元します。

第10章 GRUB をパスワードで保護する

GRUB をパスワードで保護するには、次の 2 つの方法があります。

- メニューエントリーの修正にはパスワードが必要ですが、既存のメニューエントリーの起動には必要ありません。

- メニューエントリーを変更したり、既存のメニューエントリーを起動したりするには、パスワードが必要です。

第11章 仮想化環境でカーネルパニックのパラメーターを無効のままにする

RHEL 8 に仮想マシンを設定する場合は、仮想マシンで偽ソフトロックアップが発生する可能性があるため、カーネルパラメーター softlockup_panic および nmi_watchdog を有効にしないでください。また、カーネルパニックは必要ありません。

以下のセクションで、このアドバイスの背後にある理由を見つけてください。

11.1. ソフトロックアップとは

ソフトロックアップは、通常、タスクが再スケジュールされずに CPU のカーネル領域で実行しているときにバグによって生じる状況です。また、このタスクは、その他のタスクがその特定の CPU で実行することを許可しません。これにより、警告が、システムコンソールを介してユーザーに表示されます。この問題は、ソフトロックアップの発生 (fire) とも呼ばれます。

11.2. カーネルパニックを制御するパラメーター

ソフトロックの検出時にシステムの動作を制御する、以下のカーネルパラメーターを設定できます。

softlockup_panicソフトロックアップが検出されたときにカーネルでパニックを発生させるどうかを制御します。

Expand タイプ 値 効果 整数

0

カーネルが、ソフトロックアップでパニックにならない

整数

1

カーネルが、ソフトロックアップでパニックになる

RHEL 8 では、この値はデフォルトで 0 です。

システムでパニックを発生させるには、その前にハードロックアップを検出する必要があります。検出は、

nmi_watchdogパラメーターで制御されます。nmi_watchdogロックアップ検出メカニズム (

watchdogs) がアクティブかどうかを制御します。このパラメーターは整数型です。Expand 値 効果 0

ロックアップ検出を無効にする

1

ロックアップ検出を有効にする

ハードロックアップ検出は、各 CPU で割り込みに応答する機能を監視します。

watchdog_threshウォッチドッグの

hrtimer、NMI イベント、およびソフトロックアップまたはハードロックアップのしきい値を制御します。Expand デフォルトのしきい値 ソフトロックアップのしきい値 10 秒

2 *

watchdog_threshこのパラメーターをゼロに設定すると、ロックアップ検出を無効にします。

11.3. 仮想化環境で誤ったソフトロックアップ

物理ホスト上で発生する ソフトロックアップ は、通常、カーネルまたはハードウェアのバグを表します。仮想化環境のゲストオペレーティングシステムで同じ現象が発生すると、誤った警告が表示される可能性があります。

ホストのワークロードが重い場合や、メモリーなどの特定のリソースに対する競合が激しい場合は、誤ったソフトロックアップが発生する可能性があります。これは、ホストがゲスト CPU のスケジューリングを 20 秒超中断する場合に起こります。ゲスト CPU がホスト上で再度実行されるようにスケジュールされると、時間のジャンプ が発生し、それによって期限が来たタイマーが作動します。タイマーには、ゲスト CPU のソフトロックアップを報告できる hrtimer ウォッチドッグも含まれます。

仮想化環境でのソフトロックアップは誤りである可能性があります。ソフトロックアップがゲスト CPU に報告する際にシステムパニックをトリガーするカーネルパラメーターを有効にしないでください。

ゲストのソフトロックアップを理解するには、ホストがゲストをタスクとしてスケジュールしてから、ゲストが独自のタスクをスケジュールしていることを理解することが重要になります。

第12章 データベースサーバーのカーネルパラメーターの調整

データベースサーバーとデータベースの効率的な操作を確保するには、必要なカーネルパラメーターのセットを設定する必要があります。

12.1. データベースサーバーの概要

データベースサーバーは、データベース管理システム (DBMS) の機能を提供するサービスです。DBMS は、データベース管理のためのユーティリティーを提供し、エンドユーザー、アプリケーション、およびデータベースと対話します。

Red Hat Enterprise Linux 8 は、以下のデータベース管理システムを提供します。

- MariaDB 10.3

- MariaDB 10.5 - RHEL 8.4 以降で利用できます。

- MariaDB 10.11 - RHEL 8.10 以降で利用可能

- MySQL 8.0

- PostgreSQL 10

- PostgreSQL 9.6

- PostgreSQL 12 - RHEL 8.1.1 以降で利用できます。

- PostgreSQL 13 - RHEL 8.4 以降で利用できます。

- PostgreSQL 15 - RHEL 8.8 以降で利用できます。

- PostgreSQL 16 - RHEL 8.10 以降で利用可能

12.2. データベースアプリケーションのパフォーマンスに影響するパラメーター

次のカーネルパラメーターは、データベースアプリケーションのパフォーマンスに影響します。

- fs.aio-max-nr

サーバー上でシステムが処理できる非同期 I/O 操作の最大数を定義します。

注記fs.aio-max-nrパラメーターを増やしても、aio の制限以上を追加することはありません。- fs.file-max

システムが同時にサポートするファイルハンドル (開いているファイルに割り当てられた一時ファイル名または ID) の最大数を定義します。

カーネルは、アプリケーションからファイルハンドルが要求されるたびに、ファイルハンドルを動的に割り当てます。ただし、アプリケーションによってこれらのファイルハンドルが解放されても、カーネルはそれらを解放しません。代わりにこれらのファイルハンドルをリサイクルします。現在使用されているファイルハンドルの数が少ない場合でも、割り当てられたファイルハンドルの合計数は時間の経過とともに増加します。

kernel.shmall-

システム全体で使用できる共有メモリーページの合計を定義します。メインメモリー全体を使用するには、

kernel.shmallパラメーターの値が、メインメモリーの合計サイズ以下である必要があります。 kernel.shmmax- Linux プロセスが仮想アドレス空間に割り当てることができる 1 つの共有メモリーセグメントの最大サイズをバイト単位で定義します。

kernel.shmmni- データベースサーバーが処理できる共有メモリーセグメントの最大数を定義します。

net.ipv4.ip_local_port_range- システムは、ポート番号を指定せずにデータベースサーバーに接続するプログラムにこのポート範囲を使用します。

net.core.rmem_default- TCP (Transmission Control Protocol) を介してデフォルトの受信ソケットメモリーを定義します。

net.core.rmem_max- TCP (Transmission Control Protocol) による最大受信ソケットメモリーを定義します。

net.core.wmem_default- TCP (Transmission Control Protocol) によるデフォルトの送信ソケットメモリーを定義します。

net.core.wmem_max- TCP (Transmission Control Protocol) による最大送信ソケットメモリーを定義します。

vm.dirty_bytes/vm.dirty_ratio-

ダーティーデータを生成しているプロセスが

write()関数内でディスクへの書き出しを開始する、ダーティー化可能なメモリーのしきい値を、バイト単位またはパーセンテージ単位で定義します。

一度に指定できるのは、vm.dirty_bytes または vm.dirty_ratio の いずれか です。

vm.dirty_background_bytes/vm.dirty_background_ratio- カーネルがハードディスクにダーティーデータを積極的に書き出し始める、ダーティー化可能なメモリーのしきい値を、バイト単位またはパーセンテージ単位で定義します。

一度に指定できるのは、vm.dirty_background_bytes または vm.dirty_background_ratio の いずれか です。

vm.dirty_writeback_centisecsハードディスクへのダーティーデータの書き込みを行うカーネルスレッドの起動を定期的に行う間隔を定義します。

このカーネルパラメーターは、100 分の 1 秒単位で測定されます。

vm.dirty_expire_centisecs古くなったダーティーデータが、ハードディスクに書き込まれるまでの時間を定義します。

このカーネルパラメーターは、100 分の 1 秒単位で測定されます。

第13章 カーネルロギングの使用

ログファイルは、カーネル、サービス、システム上で実行されているアプリケーションなど、システムに関するメッセージを提供します。syslog サービスは、Red Hat Enterprise Linux でのロギング用にネイティブサポートを提供します。さまざまなユーティリティーがこのシステムを使用してイベントを記録し、ログファイルにまとめます。このファイルは、オペレーティングシステムの監査や問題のトラブルシューティングに役に立ちます。

13.1. カーネルリングバッファーとは

起動プロセス中、コンソールはシステム起動の初期段階に関する重要な情報を提供します。先に出力されたメッセージが失われないように、カーネルはリングバッファーを利用します。このバッファーは、カーネルコード内の printk() 関数により生成されるブートメッセージなど、すべてのメッセージを格納します。次に、カーネルリングバッファーからのメッセージは、syslog サービスなどの永続ストレージのログファイルに読み込まれ、保存されます。

リングバッファーは、固定サイズの循環データ構造で、カーネルにハードコーディングされています。ユーザーは、dmesg コマンドまたは /var/log/boot.log ファイル介して、カーネルリングバッファーに保存されているデータを表示できます。リングバッファーが満杯になると、新しいデータにより古いデータが上書きされます。

13.2. ログレベルおよびカーネルロギングにおける printk のロール

カーネルが報告する各メッセージには、メッセージの重要性を定義するログレベルが関連付けられています。カーネルリングバッファーは、カーネルリングバッファーとは で説明されているように、すべてのログレベルのカーネルメッセージを収集します。バッファーからコンソールに出力されるメッセージを定義するのは kernel.printk パラメーターです。

ログレベルの値は、以下の順序で分類されます。

- 0

- カーネルの緊急事態。システムが利用できません。

- 1

- カーネルアラート。すぐに対処する必要があります。

- 2

- 重大な問題があると見なされるカーネルの状態。

- 3

- 一般的なカーネルのエラー状態。

- 4

- 一般的なカーネルの警告状態。

- 5

- 正常だが重要な状態に関するカーネル通知。

- 6

- カーネル情報メッセージ。

- 7

- カーネルのデバッグレベルのメッセージ。

デフォルトでは、RHEL 8 の kernel.printk には次の値があります。

sysctl kernel.printk

# sysctl kernel.printk

kernel.printk = 7 4 1 7この 4 つの値は、順に以下を定義します。

- コンソールログレベル。コンソールに出力されるメッセージの最低優先度を定義します。

- 明示的なログレベルが付いていないメッセージのデフォルトのログレベル。

- コンソールのログレベルに、可能な限り低いログレベル設定を設定します。

起動時のコンソールのログレベルのデフォルト値を設定します。

これらの各値は、エラーメッセージを処理するさまざまなルールを定義します。

デフォルトの 7 4 1 7 printk 値を使用することで、カーネルアクティビティーのデバッグを改善できます。ただし、シリアルコンソールと組み合わせると、この printk 設定により激しい I/O バーストが発生し、RHEL システムが一時的に応答しなくなる可能性があります。通常 4 4 1 7 に printk 値を設定するとこのような状況を回避できますが、代わりに追加のデバッグ情報が失われてしまいます。

また、quiet、debug などの特定のカーネルコマンドラインパラメーターにより、デフォルトの kernel.printk 値が変更される点に注意してください。

第14章 kdump のインストール

新しいバージョンの RHEL 8 インストールでは、kdump サービスはデフォルトでインストールされ、アクティブ化されます。

14.1. kdump とは

kdump は、クラッシュダンプメカニズムを提供し、クラッシュダンプまたは vmcore ダンプファイルを生成するサービスです。vmcore には、分析およびトラブルシューティング用のシステムメモリーの内容が含まれています。kdump は、kexec システムコールを使用して、再起動せずに 2 番目のカーネルである capture kernel を起動します。このカーネルはクラッシュしたカーネルのメモリーの内容をキャプチャーし、ファイルに保存します。この別のカーネルは、システムメモリーの予約部分で使用できます。

カーネルクラッシュダンプは、システム障害時に利用できる唯一の情報になります。したがって、ミッションクリティカルな環境では、kdump を稼働させることが重要です。Red Hat は、通常のカーネル更新サイクルで kexec-tools を定期的に更新してテストすることを推奨します。これは、新しいカーネル機能をインストールするときに重要です。

マシンに複数のカーネルがある場合は、インストールされているすべてのカーネルに対して、または指定したカーネルに対してのみ kdump を有効にできます。kdump をインストールすると、システムによってデフォルトの /etc/kdump.conf ファイルが作成されます。/etc/kdump.conf にはデフォルトの最小 kdump 設定が含まれています。これを編集して kdump 設定をカスタマイズできます。

14.2. Anaconda を使用した kdump のインストール

Anaconda インストーラーでは、対話式インストール時に kdump 設定用のグラフィカルインターフェイス画面が表示されます。kdump を有効にして、必要な量のメモリーを予約できます。

手順

Anaconda インストーラーで、KDUMP をクリックして

kdumpを有効にします。- メモリー予約をカスタマイズする必要がある場合は、Kdump Memory Reservation で Manual を選択します。

KDUMP > Memory To Be Reserved (MB) で、

kdumpに必要なメモリー予約を設定します。

14.3. コマンドラインで kdump のインストール

カスタムの キックスタート インストールなどのインストール方法では、kdump がデフルトでインストールまたは有効化 されない 場合があります。その場合、次の手順で kdump を有効にできます。

前提条件

- アクティブな RHEL サブスクリプションがある。

-

システムの CPU アーキテクチャー用の

kexec-toolsパッケージを含むリポジトリーがある。 -

kdump設定とターゲットの要件をすべて満たしている。詳細は サポートされている kdump 設定とターゲット を参照してください。

手順

システムに

kdumpがインストールされているかどうかを確認します。rpm -q kexec-tools

# rpm -q kexec-toolsCopy to Clipboard Copied! Toggle word wrap Toggle overflow このパッケージがインストールされている場合は以下を出力します。

kexec-tools-2.0.17-11.el8.x86_64

kexec-tools-2.0.17-11.el8.x86_64Copy to Clipboard Copied! Toggle word wrap Toggle overflow このパッケージがインストールされていない場合は以下を出力します

package kexec-tools is not installed

package kexec-tools is not installedCopy to Clipboard Copied! Toggle word wrap Toggle overflow kdumpおよび必要なパッケージをインストールします。dnf install kexec-tools

# dnf install kexec-toolsCopy to Clipboard Copied! Toggle word wrap Toggle overflow

kernel-3.10.0-693.el7 以降では、Intel IOMMU ドライバーが kdump でサポートされます。kernel-3.10.0-514[.XYZ].el7 以前のバージョンでは、応答しないキャプチャーカーネルを防ぐために、Intel IOMMU が無効化されていることを確認する必要があります。

第15章 コマンドラインで kdump の設定

kdump 用メモリーは、システムの起動時に予約されます。システムの Grand Unified Bootloader (GRUB) 設定ファイルでメモリーサイズを設定できます。メモリーサイズは、設定ファイルで指定された crashkernel= 値と、システムの物理メモリーのサイズによって異なります。

15.1. kdump サイズの見積もり

kdump 環境を計画および構築するときは、クラッシュダンプファイルに必要な容量を把握することが重要です。

makedumpfile --mem-usage コマンドは、クラッシュダンプファイルに必要な容量を推定します。また、メモリー使用量に関するレポートを生成します。このレポートは、ダンプレベルと、除外しても問題ないページを決定するのに役立ちます。

手順

次のコマンドを入力して、メモリー使用量に関するレポートを生成します。

Copy to Clipboard Copied! Toggle word wrap Toggle overflow

makedumpfile --mem-usage は、必要なメモリーをページ単位で報告します。つまり、カーネルページサイズを元に、使用するメモリーのサイズを計算する必要があります。

デフォルトでは、RHEL カーネルは、AMD64 および Intel 64 の CPU アーキテクチャーで 4KB のサイズのページを使用し、IBM POWER アーキテクチャーで 64KB のサイズのページを使用します。

15.2. メモリー使用量の設定

kdump のメモリー予約は、システムの起動中に行われます。メモリーサイズは、システムの GRUB (Grand Unified Bootloader) 設定で設定されます。メモリーサイズは、設定ファイルで指定された crashkernel= オプションの値と、システムの物理メモリーのサイズにより異なります。

crashkernel= オプションはさまざまな方法で定義できます。crashkernel= 値を指定するか、auto オプションを設定できます。crashkernel=auto パラメーターは、システムの物理メモリーの合計量に基づいて、メモリーを自動的に予約します。これを設定すると、カーネルは、キャプチャーカーネルに必要な適切な量のメモリーを自動的に予約します。これにより、OOM (Out-of-Memory) エラーの回避に役立ちます。

kdump の自動メモリー割り当ては、システムのハードウェアアーキテクチャーと利用可能なメモリーサイズによって異なります。

たとえば、AMD64 および Intel 64 の場合には、crashkernel=auto パラメーターは、利用可能なメモリーが 1GB を超える場合にのみ機能します。64 ビット ARM アーキテクチャーと IBM Power Systems には、2 GB 以上の使用可能なメモリーが必要です。

システムに、自動割り当ての最小メモリーしきい値より少ないメモリーしかない場合は、手動で予約メモリーの量を設定できます。

前提条件

- システムの root 権限がある。

-

kdump設定とターゲットの要件をすべて満たしている。詳細は サポートされている kdump 設定とターゲット を参照してください。

手順

crashkernel=オプションを準備してください。たとえば、128 MB のメモリーを予約するには、以下を使用します。

crashkernel=128M

crashkernel=128MCopy to Clipboard Copied! Toggle word wrap Toggle overflow または、インストールされているメモリーの合計量に応じて、予約メモリーサイズを変数に設定できます。変数へのメモリー予約の構文は

crashkernel=<range1>:<size1>,<range2>:<size2>です。以下に例を示します。crashkernel=512M-2G:64M,2G-:128M

crashkernel=512M-2G:64M,2G-:128MCopy to Clipboard Copied! Toggle word wrap Toggle overflow システムメモリーの合計量が 512 MB - 2 GB の範囲にある場合、64 MB のメモリーを予約します。メモリーの合計量が 2 GB を超える場合、メモリー予約は 128 MB になります。

予約メモリーのオフセット。

一部のシステムでは、

crashkernelの予約が早い段階で行われるため、特定の固定オフセットでメモリーを予約する必要があります。また、特別な用途のために、さらに多くのメモリーの予約が必要になることもあります。オフセットを定義すると、予約メモリーはそこから開始されます。予約メモリーをオフセットするには、以下の構文を使用します。crashkernel=128M@16M

crashkernel=128M@16MCopy to Clipboard Copied! Toggle word wrap Toggle overflow この例では、

kdumpは 16 MB (物理アドレス0x01000000) から始まる 128 MB のメモリーを予約します。offset パラメーターを 0 に設定するか、完全に省略すると、kdumpは予約メモリーを自動的にオフセットします。変数のメモリー予約を設定する場合は、この構文を使用することもできます。その場合、オフセットは常に最後に指定されます。以下に例を示します。crashkernel=512M-2G:64M,2G-:128M@16M

crashkernel=512M-2G:64M,2G-:128M@16MCopy to Clipboard Copied! Toggle word wrap Toggle overflow

crashkernel=オプションをブートローダー設定に適用します。grubby --update-kernel=ALL --args="crashkernel=<value>"

# grubby --update-kernel=ALL --args="crashkernel=<value>"Copy to Clipboard Copied! Toggle word wrap Toggle overflow <value>は、前のステップで準備したcrashkernel=オプションの値に置き換えます。

15.3. kdump ターゲットの設定

クラッシュダンプは通常、ローカルファイルシステムにファイルとして保存され、デバイスに直接書き込まれます。必要に応じて、NFS または SSH プロトコルを使用して、ネットワーク経由でクラッシュダンプを送信できます。クラッシュダンプファイルを保存するオプションは、一度に 1 つだけ設定できます。デフォルトの動作では、ローカルファイルシステムの /var/crash/ ディレクトリーに保存されます。

前提条件

- システムの root 権限がある。

-

kdump設定とターゲットの要件をすべて満たしている。詳細は サポートされている kdump 設定とターゲット を参照してください。

手順

ローカルファイルシステムの

/var/crash/ディレクトリーにクラッシュダンプファイルを保存するには、/etc/kdump.confファイルを変更して、パスを指定します。path /var/crash

path /var/crashCopy to Clipboard Copied! Toggle word wrap Toggle overflow path /var/crashオプションは、kdumpがクラッシュダンプファイルを保存するファイルシステムへのパスを表します。注記-

/etc/kdump.confファイルでダンプターゲットを指定すると、path は指定されたダンプ出力先に対する相対パスになります。 -

/etc/kdump.confファイルでダンプターゲットを指定しない場合、パスはルートディレクトリーからの 絶対 パスを表します。

現在のシステムにマウントされているファイルシステムに応じて、ダンプターゲットと調整されたダンプパスが自動的に設定されます。

-

kdumpによって生成されるクラッシュダンプファイルと付随するファイルを保護するには、ユーザー権限や SELinux コンテキストなど、ターゲットの宛先ディレクトリーの属性を適切に設定する必要があります。さらに、次のようにkdump.confファイルでkdump_post.shなどのスクリプトを定義することもできます。kdump_post <path_to_kdump_post.sh>

kdump_post <path_to_kdump_post.sh>Copy to Clipboard Copied! Toggle word wrap Toggle overflow kdump_postディレクティブは、kdumpがクラッシュダンプの取得と指定の保存先への保存を完了した 後に 実行されるシェルスクリプトまたはコマンドを指定するものです。このメカニズムを使用すると、kdumpの機能を拡張して、ファイル権限の調整などの操作を実行できます。-

kdumpターゲット設定

*grep -v ^# /etc/kdump.conf | grep -v ^$*

# *grep -v ^# /etc/kdump.conf | grep -v ^$*

ext4 /dev/mapper/vg00-varcrashvol

path /var/crash

core_collector makedumpfile -c --message-level 1 -d 31

ダンプターゲットが指定されています (ext4 /dev/mapper/vg00-varcrashvol)。そのため、ダンプターゲットは /var/crash にマウントされます。path オプションも /var/crash に設定されています。したがって、kdump は、vmcore ファイルを /var/crash/var/crash ディレクトリーに保存します。

クラッシュダンプを保存するローカルディレクトリーを変更するには、

rootユーザーとして/etc/kdump.conf設定ファイルを編集します。-

#path /var/crashの行頭にあるハッシュ記号 (#) を削除します。 値を対象のディレクトリーパスに置き換えます。以下に例を示します。

path /usr/local/cores

path /usr/local/coresCopy to Clipboard Copied! Toggle word wrap Toggle overflow 重要RHEL 8 では、障害を回避するために、

kdumpsystemdサービスの起動時に、pathディレクティブを使用してkdumpターゲットとして定義されたディレクトリーが存在している必要があります。以前のバージョンの RHEL とは異なり、サービス起動時にディレクトリーが存在しない場合、ディレクトリーは自動的に作成されなくなりました。

-

ファイルを別のパーティションに書き込むには、

/etc/kdump.conf設定ファイルを編集します。必要に応じて

#ext4の行頭にあるハッシュ記号 (#) を削除します。-

デバイス名 (

#ext4 /dev/vg/lv_kdump行) -

ファイルシステムラベル (

#0ext4 LABEL=/boot行) -

UUID (

#ext4 UUID=03138356-5e61-4ab3-b58e-27507ac41937の行)

-

デバイス名 (

ファイルシステムタイプとデバイス名、ラベル、または UUID を必要な値に変更します。UUID 値を指定するための正しい構文は、

UUID="correct-uuid"とUUID=correct-uuidの両方です。以下に例を示します。ext4 UUID=03138356-5e61-4ab3-b58e-27507ac41937

ext4 UUID=03138356-5e61-4ab3-b58e-27507ac41937Copy to Clipboard Copied! Toggle word wrap Toggle overflow 重要LABEL=またはUUID=を使用してストレージデバイスを指定することを推奨します。/dev/sda3などのディスクデバイス名は、再起動した場合に一貫性が保証されません。IBM Z ハードウェアで Direct Access Storage Device (DASD) を使用する場合は、

kdumpに進む前に、ダンプデバイスが/etc/dasd.confで正しく指定されていることを確認してください。

クラッシュダンプを直接書き込むには、

/etc/kdump.conf設定ファイルを修正します。-

#raw /dev/vg/lv_kdumpの行頭にあるハッシュ記号 (#) を削除します。 値を対象のデバイス名に置き換えます。以下に例を示します。

raw /dev/sdb1

raw /dev/sdb1Copy to Clipboard Copied! Toggle word wrap Toggle overflow

-

NFSプロトコルを使用してクラッシュダンプをリモートマシンに保存するには、次の手順を実行します。-

#nfs my.server.com:/export/tmpの行頭にあるハッシュ記号 (#) を削除します。 値を、正しいホスト名およびディレクトリーパスに置き換えます。以下に例を示します。

nfs penguin.example.com:/export/cores

nfs penguin.example.com:/export/coresCopy to Clipboard Copied! Toggle word wrap Toggle overflow 変更を有効にするには、

kdumpサービスを再起動します。sudo systemctl restart kdump.service

sudo systemctl restart kdump.serviceCopy to Clipboard Copied! Toggle word wrap Toggle overflow 注記NFS ディレクティブを使用して NFS ターゲットを指定すると、

kdump.serviceが自動的に NFS ターゲットをマウントしてディスク容量をチェックしようとします。NFS ターゲットを事前にマウントする必要はありません。kdump.serviceがターゲットをマウントしないようにするには、kdump.confでdracut_args --mountディレクティブを使用します。これにより、kdump.serviceが--mount引数を使用してdracutユーティリティーを呼び出して NFS ターゲットを指定できるようになります。

-

SSH プロトコルを使用してクラッシュダンプをリモートマシンに保存するには、次の手順を実行します。

-

#ssh user@my.server.comの行頭にあるハッシュ記号 (#) を削除します。 - 値を正しいユーザー名およびホスト名に置き換えます。

SSH キーを設定に含めます。

-

#sshkey /root/.ssh/kdump_id_rsaの行頭にあるハッシュ記号 (#) を削除します。 値を、ダンプ先のサーバー上の正しいキーの場所に変更します。以下に例を示します。

ssh john@penguin.example.com sshkey /root/.ssh/mykey

ssh john@penguin.example.com sshkey /root/.ssh/mykeyCopy to Clipboard Copied! Toggle word wrap Toggle overflow

-

-

15.4. kdump コアコレクターの設定

kdump では、core_collector を使用してクラッシュダンプイメージをキャプチャーします。RHEL では、makedumpfile ユーティリティーがデフォルトのコアコレクターです。これは、以下に示すプロセスによりダンプファイルを縮小するのに役立ちます。

- クラッシュダンプファイルのサイズを圧縮し、さまざまなダンプレベルを使用して必要なページのみをコピーする

- 不要なクラッシュダンプページを除外する

- クラッシュダンプに含めるページタイプをフィルタリングする

クラッシュダンプファイルの圧縮は、RHEL 7 以降ではデフォルトで有効になっています。

クラッシュダンプファイルの圧縮をカスタマイズする必要がある場合は、以下の手順に従います。

構文

core_collector makedumpfile -l --message-level 1 -d 31

core_collector makedumpfile -l --message-level 1 -d 31オプション

-

-c、-l、または-p:zlib(-cオプションの場合)、lzo(-lオプションの場合)、またはsnappy(-pオプションの場合) のいずれかを使用して、ページごとに圧縮ダンプファイルの形式を指定します。 -

-d(dump_level): ページを除外して、ダンプファイルにコピーされないようにします。 -

--message-level: メッセージタイプを指定します。このオプションでmessage_levelを指定すると、出力の表示量を制限できます。たとえば、message_levelで 7 を指定すると、一般的なメッセージとエラーメッセージを出力します。message_levelの最大値は 31 です。

前提条件

- システムの root 権限がある。

-

kdump設定とターゲットの要件をすべて満たしている。詳細は サポートされている kdump 設定とターゲット を参照してください。

手順

-

rootとして、/etc/kdump.conf設定ファイルを編集し、#core_collector makedumpfile -l --message-level 1 -d 31の先頭からハッシュ記号 ("#") を削除します。 - 次のコマンドを入力して、クラッシュダンプファイルの圧縮を有効にします。

core_collector makedumpfile -l --message-level 1 -d 31

core_collector makedumpfile -l --message-level 1 -d 31

-l オプションにより、dump の圧縮ファイル形式を指定します。-d オプションで、ダンプレベルを 31 に指定します。--message-level オプションで、メッセージレベルを 1 に指定します。

また、-c オプションおよび -p オプションを使用した以下の例を検討してください。

-cを使用してクラッシュダンプファイルを圧縮するには、次のコマンドを実行します。core_collector makedumpfile -c -d 31 --message-level 1

core_collector makedumpfile -c -d 31 --message-level 1Copy to Clipboard Copied! Toggle word wrap Toggle overflow -pを使用してクラッシュダンプファイルを圧縮するには、次のコマンドを実行します。core_collector makedumpfile -p -d 31 --message-level 1

core_collector makedumpfile -p -d 31 --message-level 1Copy to Clipboard Copied! Toggle word wrap Toggle overflow

15.5. kdump のデフォルト障害応答の設定

デフォルトでは、設定したターゲットの場所で kdump がクラッシュダンプファイルの作成に失敗すると、システムが再起動し、ダンプがプロセス内で失われます。デフォルトの失敗応答を変更し、コアダンプをプライマリーターゲットに保存できない場合に別の操作を実行するように kdump を設定できます。追加のアクションは次のとおりです。

dump_to_rootfs-

コアダンプを

rootファイルシステムに保存します。 reboot- システムを再起動します。コアダンプは失われます。

halt- システムを停止します。コアダンプは失われます。

poweroff- システムの電源を切ります。コアダンプは失われます。

shell-

initramfs内からシェルセッションを実行します。コアダンプを手動で記録できます。 final_action-

kdumpの成功後、またはシェルまたはdump_to_rootfsの失敗アクションの完了時に、reboot、haltおよびpoweroffなどの追加操作を有効にします。デフォルトはrebootです。 failure_action-

カーネルクラッシュでダンプが失敗する可能性がある場合に実行するアクションを指定します。デフォルトは

rebootです。

前提条件

- root 権限

-

kdump設定とターゲットの要件をすべて満たしている。詳細は サポートされている kdump 設定とターゲット を参照してください。

手順

-

rootユーザーとして、/etc/kdump.conf設定ファイルの#failure_action行の先頭からハッシュ記号 (#) を削除します。 値を必要なアクションに置き換えます。

failure_action poweroff

failure_action poweroffCopy to Clipboard Copied! Toggle word wrap Toggle overflow

15.6. kdump の設定ファイル

kdump カーネルの設定ファイルは /etc/sysconfig/kdump です。このファイルは、kdump カーネルコマンドラインパラメーターを制御します。ほとんどの設定では、デフォルトオプションを使用します。ただし、シナリオによっては、kdump カーネルの動作を制御するために特定のパラメーターを変更する必要があります。たとえば、KDUMP_COMMANDLINE_APPEND オプションを変更して kdump カーネルコマンドラインを追加して詳細なデバッグ出力を取得したり、KDUMP_COMMANDLINE_REMOVE オプションを変更して kdump コマンドラインから引数を削除したりします。

KDUMP_COMMANDLINE_REMOVE現在の

kdumpコマンドラインから引数を削除します。これにより、kdumpエラーやkdumpカーネルの起動失敗の原因となるパラメーターが削除されます。これらのパラメーターは、以前のKDUMP_COMMANDLINEプロセスから解析されるか、/proc/cmdlineファイルから継承されたものである場合があります。この変数が設定されていない場合は、

/proc/cmdlineファイルからすべての値が継承されます。このオプションを設定すると、問題のデバッグに役立つ情報も提供されます。特定の引数を削除するには、以下のようにして

KDUMP_COMMANDLINE_REMOVEに追加します。

KDUMP_COMMANDLINE_REMOVE="hugepages hugepagesz slub_debug quiet log_buf_len swiotlb"

# KDUMP_COMMANDLINE_REMOVE="hugepages hugepagesz slub_debug quiet log_buf_len swiotlb"KDUMP_COMMANDLINE_APPENDこのオプションは、現在のコマンドラインに引数を追加します。この引数は、以前の

KDUMP_COMMANDLINE_REMOVE変数によって解析されたものである場合があります。kdumpカーネルの場合は、mce、cgroup、numa、hest_disableなどの特定のモジュールを無効にすると、カーネルエラーを防ぐのに役立ちます。これらのモジュールは、kdump用に予約されているカーネルメモリーの大部分を消費したり、kdumpカーネルの起動失敗を引き起こしたりする可能性があります。kdumpカーネルコマンドラインでメモリーcgroupを無効にするには、以下のコマンドを実行します。

KDUMP_COMMANDLINE_APPEND="cgroup_disable=memory"

KDUMP_COMMANDLINE_APPEND="cgroup_disable=memory"15.7. kdump 設定のテスト

kdump を設定したら、システムクラッシュを手動でテストして、定義した kdump ターゲットに vmcore ファイルが生成されていることを確認する必要があります。vmcore ファイルは、新しく起動したカーネルのコンテキストからキャプチャーされます。したがって、vmcore にはカーネルクラッシュをデバッグするための重要な情報が含まれています。

アクティブな実稼働システムでは kdump をテストしないでください。kdump をテストするコマンドにより、カーネルがクラッシュし、データが失われます。システムアーキテクチャーに応じて、十分なメンテナンス時間を必ず確保してください。kdump のテストでは時間のかかる再起動が数回必要になる場合があります。

kdump のテスト中に vmcore ファイルが生成されない場合は、kdump のテストを成功させるために、再度テストを実行する前に問題を特定して修正してください。

手動でシステムを変更した場合は、システム変更の最後に kdump 設定をテストする必要があります。たとえば、次のいずれかの変更を行った場合は、kdump のパフォーマンスが最適になるように、kdump の設定をテストしてください。

- パッケージのアップグレード。

- ハードウェアレベルの変更 (ストレージやネットワークの変更など)。

- ファームウェアのアップグレード。

- サードパーティーのモジュールを含む新規のインストールおよびアプリケーションのアップグレード。

- ホットプラグメカニズムを使用した、このメカニズムをサポートするハードウェアへのメモリーの追加。

-

/etc/kdump.confファイルまたは/etc/sysconfig/kdumpファイルに対する変更。

前提条件

- システムの root 権限がある。

-

重要なデータがすべて保存されている。

kdumpをテストするコマンドにより、カーネルがクラッシュし、データが失われます。 - システムアーキテクチャーに応じて、十分なマシンメンテナンス時間が確保されている。

手順

kdumpサービスを有効にします。kdumpctl restart

# kdumpctl restartCopy to Clipboard Copied! Toggle word wrap Toggle overflow kdumpctlを使用してkdumpサービスのステータスを確認します。kdumpctl status

# kdumpctl status kdump:Kdump is operationalCopy to Clipboard Copied! Toggle word wrap Toggle overflow 必要に応じて

systemctlコマンドを使用すると、出力がsystemdジャーナルに印刷されます。カーネルクラッシュを開始して、

kdumpの設定をテストします。sysrq-triggerキーの組み合わせによりカーネルがクラッシュし、必要に応じてシステムが再起動します。echo c > /proc/sysrq-trigger

# echo c > /proc/sysrq-triggerCopy to Clipboard Copied! Toggle word wrap Toggle overflow カーネルの再起動時に、

/etc/kdump.confファイルで指定した場所にaddress-YYYY-MM-DD-HH:MM:SS/vmcoreファイルが作成されます。デフォルトは/var/crash/です。

15.8. システムクラッシュ後に kdump によって生成されるファイル

システムがクラッシュすると、kdump サービスは、カーネルメモリーをダンプファイル (vmcore) にキャプチャーします。また、トラブルシューティングと事後分析に役立つ追加の診断ファイルを生成します。

kdump によって生成されるファイル:

-

vmcore- クラッシュ時のシステムメモリーを含む主なカーネルメモリーダンプファイル。これには、kdump設定で指定されているcore_collectorプログラムの設定に従ってデータが追加されます。デフォルトでは、カーネルデータ構造、プロセス情報、スタックトレース、およびその他の診断情報が含まれます。 -

vmcore-dmesg.txt- パニックになったプライマリーカーネルからのカーネルリングバッファーログ (dmesg) の内容。 -

kexec-dmesg.log-vmcoreデータを収集するセカンダリーのkexecカーネルの実行に基づくカーネルおよびシステムログメッセージが含まれます。

15.9. kdump サービスの有効化および無効化

kdump 機能は、特定のカーネルまたはインストールされているすべてのカーネルで有効または無効にするように設定できます。kdump 機能を定期的にテストし、正しく動作することを検証する必要があります。

前提条件

- システムの root 権限がある。

-

kdumpの設定とターゲットの要件をすべて満たしている。サポートされている kdump 設定とターゲット を参照してください。 -

kdumpをインストールするためのすべての設定が、要件に応じてセットアップされている。

手順

multi-user.targetのkdumpサービスを有効にします。systemctl enable kdump.service

# systemctl enable kdump.serviceCopy to Clipboard Copied! Toggle word wrap Toggle overflow 現在のセッションでサービスを起動します。

systemctl start kdump.service

# systemctl start kdump.serviceCopy to Clipboard Copied! Toggle word wrap Toggle overflow kdumpサービスを停止します。systemctl stop kdump.service

# systemctl stop kdump.serviceCopy to Clipboard Copied! Toggle word wrap Toggle overflow kdumpサービスを無効にします。systemctl disable kdump.service

# systemctl disable kdump.serviceCopy to Clipboard Copied! Toggle word wrap Toggle overflow

kptr_restrict=1 をデフォルトとして設定することが推奨されます。kptr_restrict がデフォルトで (1) に設定されている場合、Kernel Address Space Layout (KASLR) が有効かどうかに関係なく、kdumpctl サービスがクラッシュカーネルをロードします。

kptr_restrict が 1 に設定されておらず、KASLR が有効になっている場合は、/proc/kore ファイルの内容がすべてゼロとして生成されます。kdumpctl サービスは、/proc/kcore ファイルにアクセスしてクラッシュカーネルを読み込むことができません。kexec-kdump-howto.txt ファイルには、kptr_restrict=1 に設定することを推奨する警告メッセージが表示されます。kdumpctl サービスが必ずクラッシュカーネルを読み込むように、sysctl.conf ファイルで次の内容を確認します。

-