1.5. 클러스터 라이프사이클 소개

멀티 클러스터 엔진 Operator는 OpenShift Container Platform 및 Red Hat Advanced Cluster Management Hub 클러스터에 대한 클러스터 관리 기능을 제공하는 클러스터 라이프사이클 Operator입니다. 다중 클러스터 엔진 Operator는 클러스터 관리를 개선하고 클라우드 및 데이터 센터 전체에서 OpenShift Container Platform 클러스터 라이프사이클 관리를 지원하는 소프트웨어 운영자입니다. Red Hat Advanced Cluster Management를 사용하거나 사용하지 않고 다중 클러스터 엔진 Operator를 사용할 수 있습니다. Red Hat Advanced Cluster Management는 멀티 클러스터 엔진 Operator도 자동으로 설치하고 추가 다중 클러스터 기능을 제공합니다.

다음 설명서를 참조하십시오.

- 클러스터 라이프사이클 아키텍처

- 인증 정보 관리 개요

- 호스트 인벤토리 소개

- CLI를 사용하여 클러스터 생성

- 클러스터 생성 중 추가 매니페스트 구성

- Amazon Web Services에서 클러스터 생성

- Amazon Web Services GovCloud에서 클러스터 생성

- Microsoft Azure에 클러스터 생성

- Google Cloud Platform에서 클러스터 생성

- VMware vSphere에서 클러스터 생성

- Red Hat OpenStack Platform에서 클러스터 생성

- Red Hat Virtualization에서 클러스터 생성 (더 이상 사용되지 않음)

- 온프레미스 환경에서 클러스터 생성

- 프록시 환경에서 클러스터 생성

- 클러스터에 액세스

- 관리형 클러스터 확장

- 생성된 클러스터 완화

- 클러스터 프록시 애드온 활성화

- 관리 클러스터에서 실행되도록 Ansible Automation Platform 작업 구성

- 배치

- ManagedServiceAccount 활성화

- 클러스터 라이프사이클 고급 구성

- 관리에서 클러스터 제거

1.5.1. 클러스터 라이프사이클 아키텍처

클러스터 라이프사이클에는 허브 클러스터와 관리 클러스터의 두 가지 유형이 필요합니다.

hub 클러스터는 다중 클러스터 엔진 Operator가 자동으로 설치된 OpenShift Container Platform (또는 Red Hat Advanced Cluster Management) 기본 클러스터입니다. hub 클러스터를 사용하여 다른 Kubernetes 클러스터를 생성, 관리 및 모니터링할 수 있습니다. hub 클러스터에서 관리할 기존 클러스터를 가져오는 동안 hub 클러스터를 사용하여 클러스터를 생성할 수 있습니다.

관리형 클러스터를 생성할 때 Hive 리소스와 함께 Red Hat OpenShift Container Platform 클러스터 설치 프로그램을 사용하여 클러스터가 생성됩니다. OpenShift Container Platform 설치 프로그램을 사용하여 클러스터 설치 프로세스에 대한 자세한 내용은 OpenShift Container Platform 설명서에서 OpenShift Container Platform 클러스터 설치 및 구성 을 읽고 확인할 수 있습니다.

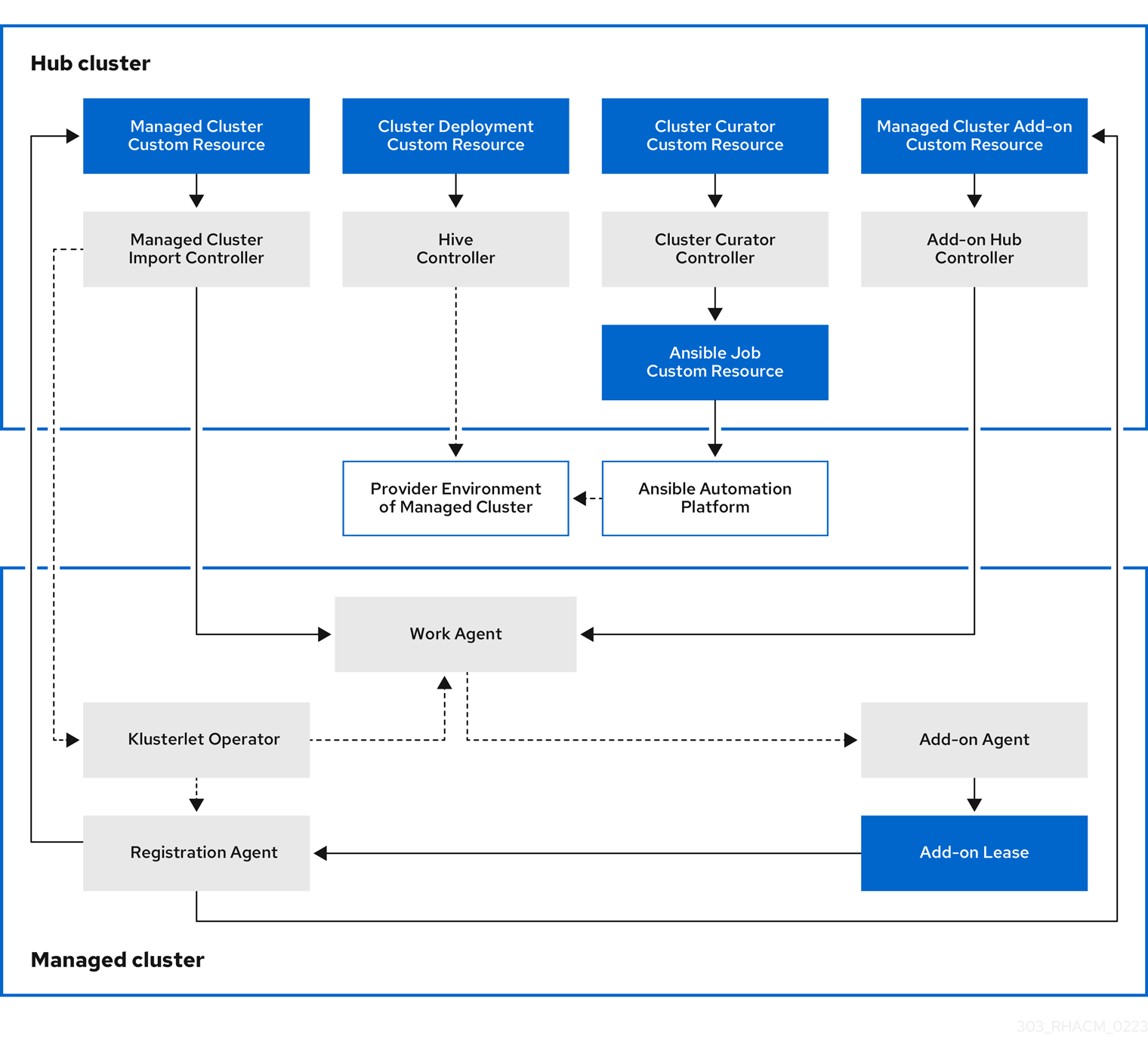

다음 다이어그램은 클러스터 관리를 위해 Kubernetes Operator용 다중 클러스터 엔진과 함께 설치된 구성 요소를 보여줍니다.

클러스터 라이프사이클 관리 아키텍처의 구성 요소에는 다음 항목이 포함됩니다.

1.5.1.1. hub 클러스터

- 관리 클러스터 가져오기 컨트롤러는 klusterlet Operator를 관리 클러스터에 배포합니다.

- Hive 컨트롤러는 Kubernetes Operator에 다중 클러스터 엔진을 사용하여 생성하는 클러스터를 프로비저닝합니다. Hive 컨트롤러는 Kubernetes Operator를 위해 다중 클러스터 엔진에 의해 생성된 관리형 클러스터도 제거합니다.

- 클러스터 큐레이터 컨트롤러는 관리 클러스터를 생성하거나 업그레이드할 때 클러스터 인프라 환경을 구성하기 위해 pre-hook 또는 post-hook로 Ansible 작업을 생성합니다.

- hub 클러스터에서 관리되는 클러스터 애드온이 활성화되면 허브 클러스터에 해당 애드온 허브 컨트롤러가 배포됩니다. 애드온 허브 컨트롤러는 관리형 클러스터에 애드온 에이전트 를 배포합니다.

1.5.1.2. 관리형 클러스터

- klusterlet Operator 는 관리 클러스터에 등록 및 작업 컨트롤러를 배포합니다.

등록 에이전트 는 관리 클러스터와 관리형 클러스터 애드온을 hub 클러스터에 등록합니다. 또한 등록 에이전트는 관리 클러스터 및 관리 클러스터 애드온의 상태를 유지 관리합니다. 다음 권한은 관리 클러스터가 hub 클러스터에 액세스할 수 있도록 Clusterrole 내에 자동으로 생성됩니다.

- 에이전트가 hub 클러스터에서 관리하는 소유 클러스터를 가져오거나 업데이트할 수 있습니다.

- 에이전트가 hub 클러스터에서 관리하는 소유 클러스터의 상태를 업데이트할 수 있습니다.

- 에이전트가 인증서를 회전하도록 허용

-

에이전트가 reconcile

.k8s.io리스를얻거나업데이트하도록 허용 -

에이전트가 관리 클러스터 애드온을

가져올 수있도록 허용 - 에이전트가 관리 클러스터 애드온의 상태를 업데이트하도록 허용

- 작업 에이전트 는 Add-on Agent를 관리 클러스터에 적용합니다. 관리 클러스터가 hub 클러스터에 액세스할 수 있도록 허용하는 권한은 Clusterrole 내에서 자동으로 생성되고 에이전트가 hub 클러스터에 이벤트를 보낼 수 있습니다.

클러스터를 계속 추가하고 관리하려면 클러스터 라이프사이클 소개 를 참조하십시오.

1.5.2. 이미지 릴리스

클러스터를 빌드할 때 릴리스 이미지가 지정하는 Red Hat OpenShift Container Platform 버전을 사용하십시오. 기본적으로 OpenShift Container Platform은 clusterImageSets 리소스를 사용하여 지원되는 릴리스 이미지 목록을 가져옵니다.

계속 읽고 릴리스 이미지에 대한 자세한 내용을 확인하십시오.

1.5.2.1. 릴리스 이미지 지정

Kubernetes Operator에 다중 클러스터 엔진을 사용하여 공급자에 클러스터를 생성하는 경우 새 클러스터에 사용할 릴리스 이미지를 지정합니다. 릴리스 이미지를 지정하려면 다음 항목을 참조하십시오.

1.5.2.1.1. ClusterImageSets위치

릴리스 이미지를 참조하는 YAML 파일은 acm-hive-openshift-releases GitHub 리포지토리에서 유지 관리됩니다. 파일은 콘솔에서 사용 가능한 릴리스 이미지 목록을 생성하는 데 사용됩니다. 여기에는 OpenShift Container Platform의 최신 빠른 채널 이미지가 포함됩니다.

콘솔에는 세 가지 최신 버전의 OpenShift Container Platform의 최신 릴리스 이미지만 표시됩니다. 예를 들어 콘솔 옵션에 다음 릴리스 이미지가 표시될 수 있습니다.

quay.io/openshift-release-dev/ocp-release:4.13.1-x86_64

콘솔에 최신 릴리스 이미지로 클러스터를 생성하는 데 도움이 되는 최신 버전이 표시됩니다. 특정 버전의 클러스터를 생성해야 하는 경우 이전 릴리스 이미지 버전도 사용할 수 있습니다.

참고: 콘솔에 클러스터를 생성할 때 표시되는 이미지: 'true' 레이블이 있는 이미지만 선택할 수 있습니다. ClusterImageSet 리소스의 이 레이블의 예는 다음 콘텐츠에 제공됩니다. 4.x.1 을 제품의 현재 버전으로 바꿉니다.

apiVersion: hive.openshift.io/v1

kind: ClusterImageSet

metadata:

labels:

channel: fast

visible: 'true'

name: img4.x.1-x86-64-appsub

spec:

releaseImage: quay.io/openshift-release-dev/ocp-release:4.x.1-x86_64추가 릴리스 이미지가 저장되지만 콘솔에는 표시되지 않습니다. 사용 가능한 모든 릴리스 이미지를 보려면 다음 명령을 실행합니다.

oc get clusterimageset

리포지토리에는 릴리스 이미지로 작업할 때 사용하는 디렉터리인 clusterImageSets 디렉터리가 있습니다. clusterImageSets 디렉터리에는 다음과 같은 디렉터리가 있습니다.

- fast: 지원되는 각 OpenShift Container Platform 버전에 대한 최신 버전의 릴리스 이미지를 참조하는 파일이 포함되어 있습니다. 이 폴더의 릴리스 이미지는 테스트, 확인 및 지원됩니다.

릴리스: 각 OpenShift Container Platform 버전 (stable, fast, and candidate 채널)의 모든 릴리스 이미지를 참조하는 파일이 포함되어 있습니다.

참고: 이 릴리스는 모두 테스트된 것이 아니며 안정적인 것으로 확인되었습니다.

stable: 지원되는 각 OpenShift Container Platform 버전에 대해 안정적인 최신 버전의 릴리스 이미지를 참조하는 파일이 포함되어 있습니다.

참고: 기본적으로 현재 릴리스 이미지 목록은 시간마다 한 번씩 업데이트됩니다. 제품을 업그레이드한 후 새 버전의 제품에 권장되는 릴리스 이미지 버전을 반영하는 데 최대 1시간이 걸릴 수 있습니다.

1.5.2.1.2. ClusterImageSets구성

다음 옵션을 사용하여 ClusterImageSet 을 구성할 수 있습니다.

옵션 1: 콘솔에서 클러스터를 만들려면 원하는 특정

ClusterImageSet에 대한 이미지 참조를 지정합니다. 유지를 지정하는 각 새 항목은 향후 모든 클러스터 프로비저닝에 대해 사용할 수 있으며 다음 예제 항목을 참조하십시오.quay.io/openshift-release-dev/ocp-release:4.6.8-x86_64-

옵션 2:

acm-hive-openshift-releasesGitHub 리포지토리에서ClusterImageSetsYAML 파일을 수동으로 생성하고 적용합니다. -

옵션 3: 분기된 GitHub 리포지토리에서

ClusterImageSets의 자동 업데이트를 활성화하려면 cluster-image-set-controller GitHub 리포지토리의README.md를 따릅니다.

1.5.2.1.3. 다른 아키텍처에 클러스터를 배포할 릴리스 이미지 생성

두 아키텍처의 파일이 있는 릴리스 이미지를 수동으로 생성하여 허브 클러스터의 아키텍처와 다른 아키텍처에 클러스터를 생성할 수 있습니다.

예를 들어 ppc64le,aarch64 또는 s390x 아키텍처에서 실행 중인 hub 클러스터에서 x86_64 클러스터를 생성해야 할 수 있습니다. 두 파일 세트를 모두 사용하여 릴리스 이미지를 생성하는 경우 새 릴리스 이미지를 사용하면 OpenShift Container Platform 릴리스 레지스트리에서 다중 아키텍처 이미지 매니페스트를 제공할 수 있으므로 클러스터 생성이 성공합니다.

OpenShift Container Platform 4.13 이상에서는 기본적으로 여러 아키텍처를 지원합니다. 다음 clusterImageSet 을 사용하여 클러스터를 프로비저닝할 수 있습니다. 4.x.0 을 현재 버전으로 바꿉니다.

apiVersion: hive.openshift.io/v1

kind: ClusterImageSet

metadata:

labels:

channel: fast

visible: 'true'

name: img4.x.0-multi-appsub

spec:

releaseImage: quay.io/openshift-release-dev/ocp-release:4.x.0-multi여러 아키텍처를 지원하지 않는 OpenShift Container Platform 이미지의 릴리스 이미지를 생성하려면 아키텍처 유형에 대해 다음 예와 유사한 단계를 완료합니다.

OpenShift Container Platform 릴리스 레지스트리에서

x86_64,s390x,aarch64,ppc64le릴리스 이미지가 포함된 매니페스트 목록을 생성합니다.다음 예제 명령을 실행하여 Quay 리포지토리에서 두 아키텍처 모두에 대한 매니페스트 목록을 가져옵니다.

4.x.1을 제품의 현재 버전으로 바꿉니다.podman pull quay.io/openshift-release-dev/ocp-release:4.x.1-x86_64 podman pull quay.io/openshift-release-dev/ocp-release:4.x.1-ppc64le podman pull quay.io/openshift-release-dev/ocp-release:4.x.1-s390x podman pull quay.io/openshift-release-dev/ocp-release:4.x.1-aarch64다음 명령을 실행하여 이미지를 유지 관리하는 개인 리포지토리에 로그인합니다. &

lt;private-repo>를 리포지토리 경로로 바꿉니다.podman login <private-repo>환경에 적용되는 다음 명령을 실행하여 프라이빗 리포지토리에 릴리스 이미지 매니페스트를 추가합니다.

4.x.1을 제품의 현재 버전으로 바꿉니다. <private-repo>를 리포지토리 경로로 바꿉니다.podman push quay.io/openshift-release-dev/ocp-release:4.x.1-x86_64 <private-repo>/ocp-release:4.x.1-x86_64 podman push quay.io/openshift-release-dev/ocp-release:4.x.1-ppc64le <private-repo>/ocp-release:4.x.1-ppc64le podman push quay.io/openshift-release-dev/ocp-release:4.x.1-s390x <private-repo>/ocp-release:4.x.1-s390x podman push quay.io/openshift-release-dev/ocp-release:4.x.1-aarch64 <private-repo>/ocp-release:4.x.1-aarch64다음 명령을 실행하여 새 정보에 대한 매니페스트를 생성합니다.

podman manifest create mymanifest다음 명령을 실행하여 두 릴리스 이미지에 대한 참조를 매니페스트 목록에 추가합니다.

4.x.1을 제품의 현재 버전으로 바꿉니다. <private-repo>를 리포지토리 경로로 바꿉니다.podman manifest add mymanifest <private-repo>/ocp-release:4.x.1-x86_64 podman manifest add mymanifest <private-repo>/ocp-release:4.x.1-ppc64le podman manifest add mymanifest <private-repo>/ocp-release:4.x.1-s390x podman manifest add mymanifest <private-repo>/ocp-release:4.x.1-aarch64다음 명령을 실행하여 매니페스트 목록의 목록을 기존 매니페스트와 병합합니다. &

lt;private-repo>를 리포지토리 경로로 바꿉니다.4.x.1을 현재 버전으로 바꿉니다.podman manifest push mymanifest docker://<private-repo>/ocp-release:4.x.1

허브 클러스터에서 리포지토리의 매니페스트를 참조하는 릴리스 이미지를 생성합니다.

다음 예와 유사한 정보가 포함된 YAML 파일을 생성합니다. &

lt;private-repo>를 리포지토리 경로로 바꿉니다.4.x.1을 현재 버전으로 바꿉니다.apiVersion: hive.openshift.io/v1 kind: ClusterImageSet metadata: labels: channel: fast visible: "true" name: img4.x.1-appsub spec: releaseImage: <private-repo>/ocp-release:4.x.1허브 클러스터에서 다음 명령을 실행하여 변경 사항을 적용합니다. &

lt;file-name>을 이전 단계에서 생성한 YAML 파일의 이름으로 바꿉니다.oc apply -f <file-name>.yaml

- OpenShift Container Platform 클러스터를 생성할 때 새 릴리스 이미지를 선택합니다.

- Red Hat Advanced Cluster Management 콘솔을 사용하여 관리 클러스터를 배포하는 경우 클러스터 생성 프로세스 중 Architecture 필드에 관리 클러스터의 아키텍처를 지정합니다.

생성 프로세스에서는 병합된 릴리스 이미지를 사용하여 클러스터를 생성합니다.

1.5.2.1.4. 추가 리소스

- 릴리스 이미지를 참조하는 YAML 파일의 acm-hive-openshift-releases GitHub 리포지토리를 참조하십시오.

-

분기된 GitHub 리포지토리에서

ClusterImageSet의 자동 업데이트를 활성화하는 방법을 알아보려면 cluster-image-set-controller GitHub 리포지토리를 참조하십시오.

1.5.2.2. 연결된 경우 사용자 정의 릴리스 이미지 목록 유지

모든 클러스터에 동일한 릴리스 이미지를 사용해야 할 수 있습니다. 단순화하기 위해 클러스터를 생성할 때 사용할 수 있는 고유한 릴리스 이미지 목록을 생성할 수 있습니다. 사용 가능한 릴리스 이미지를 관리하려면 다음 단계를 완료합니다.

- acm-hive-openshift-releases GitHub 를 분기합니다.

-

클러스터를 생성할 때 사용할 수 있는 이미지의 YAML 파일을 추가합니다. Git 콘솔 또는 터미널을 사용하여 이미지를

./clusterImageSets/stable/또는./clusterImageSets/fast/디렉터리에 추가합니다. -

cluster-image-set-git-repo라는multicluster-engine네임스페이스에ConfigMap을 생성합니다. 다음 예제를 참조하지만2.x를 2.5로 바꿉니다.

apiVersion: v1

kind: ConfigMap

metadata:

name: cluster-image-set-git-repo

namespace: multicluster-engine

data:

gitRepoUrl: <forked acm-hive-openshift-releases repository URL>

gitRepoBranch: backplane-<2.x>

gitRepoPath: clusterImageSets

channel: <fast or stable>다음 절차에 따라 분기된 리포지토리에 변경 사항을 병합하여 기본 리포지토리에서 사용 가능한 YAML 파일을 검색할 수 있습니다.

- 분기된 리포지토리에 변경 사항을 커밋하고 병합합니다.

-

acm-hive-openshift-releases리포지토리를 복제한 후 빠른 릴리스 이미지 목록을 동기화하려면cluster-image-set-git-repoConfigMap의 channel 필드를fast로 업데이트합니다. -

안정적인 릴리스 이미지를 동기화하고 표시하려면

cluster-image-set-git-repoConfigMap의 channel 필드 값을stable로 업데이트합니다.

ConfigMap 을 업데이트한 후 사용 가능한 안정적인 릴리스 이미지 목록이 약 1분 내에 현재 사용 가능한 이미지로 업데이트됩니다.

다음 명령을 사용하여 사용 가능한 항목을 나열하고 기본값을 제거할 수 있습니다. &

lt;clusterImageSet_NAME>을 올바른 이름으로 바꿉니다.oc get clusterImageSets oc delete clusterImageSet <clusterImageSet_NAME>

클러스터를 생성할 때 콘솔에서 현재 사용 가능한 릴리스 이미지 목록을 확인합니다.

ConfigMap 을 통해 사용할 수 있는 다른 필드에 대한 자세한 내용은 cluster-image-set-controller GitHub 리포지토리 README를 참조하십시오.

1.5.2.3. 연결이 끊긴 동안 사용자 정의 릴리스 이미지 목록 유지 관리

hub 클러스터에 인터넷 연결이 없는 경우 사용자 정의 릴리스 이미지 목록을 유지 관리해야 하는 경우도 있습니다. 클러스터를 생성할 때 사용 가능한 자체 릴리스 이미지 목록을 생성할 수 있습니다. 연결이 끊긴 동안 사용 가능한 릴리스 이미지를 관리하려면 다음 단계를 완료합니다.

- 연결된 시스템에 있는 동안 acm-hive-openshift-releases GitHub 리포지토리로 이동하여 사용 가능한 클러스터 이미지 세트에 액세스합니다.

-

연결이 끊긴 다중 클러스터 엔진 Operator 클러스터에 액세스할 수 있는 시스템에

clusterImageSets디렉터리를 복사합니다. 관리 클러스터에 적합한 다음 단계를 완료하여 관리 클러스터와 클러스터 이미지 세트와 연결이 끊긴 리포지토리 간의 매핑을 추가합니다.

-

OpenShift Container Platform 관리형 클러스터의 경우

ImageContentSourcePolicy개체를 사용하여 매핑을 완료하는 방법에 대한 자세한 내용은 이미지 레지스트리 저장소 미러링 구성 을 참조하십시오. -

OpenShift Container Platform 클러스터가 아닌 관리형 클러스터의 경우

ManageClusterImageRegistry사용자 정의 리소스 정의를 사용하여 이미지 세트의 위치를 재정의합니다. 매핑에 대한 클러스터를 재정의하는 방법에 대한 정보는 가져오기에서 관리 클러스터에서 레지스트리 이미지 지정을 참조하십시오.

-

OpenShift Container Platform 관리형 클러스터의 경우

-

콘솔 또는 CLI를 사용하여

clusterImageSetYAML 콘텐츠를 수동으로 추가하여 클러스터를 생성할 때 사용할 수 있는 이미지의 YAML 파일을 추가합니다. 이미지를 저장하는 올바른 오프라인 리포지토리를 참조하도록 나머지 OpenShift Container Platform 릴리스 이미지의

clusterImageSetYAML 파일을 수정합니다. 업데이트는spec.releaseImage에서 릴리스 이미지의 오프라인 이미지 레지스트리를 사용하고 다이제스트에서 릴리스 이미지를 참조하는 다음 예와 유사합니다.apiVersion: hive.openshift.io/v1 kind: ClusterImageSet metadata: labels: channel: fast name: img<4.x.x>-x86-64-appsub spec: releaseImage: IMAGE_REGISTRY_IPADDRESS_or__DNSNAME/REPO_PATH/ocp-release@sha256:073a4e46289be25e2a05f5264c8f1d697410db66b960c9ceeddebd1c61e58717- 이미지가 YAML 파일에서 참조되는 오프라인 이미지 레지스트리에 로드되었는지 확인합니다.

다음 명령을 실행하여 이미지 다이제스트를 가져옵니다.

oc adm release info <tagged_openshift_release_image> | grep "Pull From"&

lt;tagged_openshift_release_image>를 지원되는 OpenShift Container Platform 버전에 대한 태그된 이미지로 바꿉니다. 다음 예제 출력을 참조하십시오.Pull From: quay.io/openshift-release-dev/ocp-release@sha256:69d1292f64a2b67227c5592c1a7d499c7d00376e498634ff8e1946bc9ccdddfe이미지 태그 및 다이제스트에 대한 자세한 내용은 이미지 스트림의 이미지 참조를 참조하십시오.

각 YAML 파일에 다음 명령을 입력하여 각

clusterImageSets를 생성합니다.oc create -f <clusterImageSet_FILE>clusterImageSet_FILE을 클러스터 이미지 세트 파일의 이름으로 교체합니다. 예를 들면 다음과 같습니다.oc create -f img4.11.9-x86_64.yaml추가할 각 리소스에 대해 이 명령을 실행하면 사용 가능한 릴리스 이미지 목록을 사용할 수 있습니다.

-

또는 클러스터 콘솔 생성에 이미지 URL을 직접 붙여넣을 수 있습니다. 이미지 URL을 추가하면 새

clusterImageSets가 없는 경우 생성됩니다. - 클러스터를 생성할 때 콘솔에서 현재 사용 가능한 릴리스 이미지 목록을 확인합니다.

1.5.3. 호스트 인벤토리 소개

호스트 인벤토리 관리 및 온-프레미스 클러스터 설치는 다중 클러스터 엔진 Operator 중앙 인프라 관리 기능을 사용하여 사용할 수 있습니다. 중앙 인프라 관리는 허브 클러스터에서 Operator로 지원 설치 관리자 (인프라 운영자라고도 함)를 실행합니다.

콘솔을 사용하여 온프레미스 OpenShift Container Platform 클러스터를 생성하는 데 사용할 수 있는 베어 메탈 또는 가상 머신 풀인 호스트 인벤토리를 생성할 수 있습니다. 이러한 클러스터는 컨트롤 플레인 전용 머신 또는 컨트롤 플레인의 전용 머신이 있는 독립 실행형 클러스터일 수 있습니다. 여기서 컨트롤 플레인은 허브 클러스터에서 Pod로 실행됩니다. ../../html-single/clusters#hosted-control-planes-intro

ZTP(ZTP)를 사용하여 콘솔, API 또는 GitOps를 사용하여 독립 실행형 클러스터를 설치할 수 있습니다. ZTP에 대한 자세한 내용은 Red Hat OpenShift Container Platform 설명서의 연결이 끊긴 환경에 GitOps ZTP 설치를 참조하십시오.

시스템은 Discovery Image로 부팅한 후 호스트 인벤토리를 결합합니다. Discovery Image는 다음이 포함된 Red Hat CoreOS 라이브 이미지입니다.

- 검색, 검증 및 설치 작업을 수행하는 에이전트입니다.

- 해당하는 경우 엔드포인트, 토큰, 정적 네트워크 구성을 포함하여 허브 클러스터에서 서비스에 연결하는 데 필요한 구성입니다.

일반적으로 공통 속성 세트를 공유하는 호스트 세트인 각 인프라 환경에 대해 단일 검색 이미지가 있습니다. InfraEnv 사용자 정의 리소스 정의는 이 인프라 환경 및 관련 Discovery Image를 나타냅니다. 사용되는 이미지는 선택한 운영 체제 버전을 결정하는 OpenShift Container Platform 버전을 기반으로 합니다.

호스트가 부팅되고 에이전트가 서비스에 연결되면 서비스는 해당 호스트를 나타내는 허브 클러스터에 새 Agent 사용자 정의 리소스를 생성합니다. 에이전트 리소스는 호스트 인벤토리를 구성합니다.

나중에 OpenShift 노드로 인벤토리에 호스트를 설치할 수 있습니다. 에이전트는 필요한 구성과 함께 운영 체제를 디스크에 쓰고 호스트를 재부팅합니다.

참고: Red Hat Advanced Cluster Management 2.9 이상 및 중앙 인프라 관리는 Nutanix 가상 머신을 생성하여 추가 구성이 필요한 AgentClusterInstall 을 사용하여 Nutanix 플랫폼을 지원합니다. 자세한 내용은 지원 설치 관리자 설명서의 선택적: Nutanix에 설치를 참조하십시오.

호스트 인벤토리 및 중앙 인프라 관리에 대해 자세히 알아보려면 계속 읽으십시오.

1.5.3.1. 중앙 인프라 관리 서비스 활성화

중앙 인프라 관리 서비스는 다중 클러스터 엔진 Operator와 함께 제공되며 OpenShift Container Platform 클러스터를 배포합니다. 허브 클러스터에서 MultiClusterHub Operator를 활성화하면 중앙 인프라 관리는 자동으로 배포되지만 서비스를 수동으로 활성화해야 합니다.

1.5.3.1.1. 사전 요구 사항

중앙 인프라 관리 서비스를 활성화하기 전에 다음 사전 요구 사항을 참조하십시오.

- 지원되는 Red Hat Advanced Cluster Management for Kubernetes 버전이 있는 OpenShift Container Platform 4.13 이상에 배포된 허브 클러스터가 있어야 합니다.

- 허브 클러스터(연결됨)에 대한 인터넷 액세스 또는 환경 생성에 필요한 이미지를 검색하기 위해 인터넷에 연결되어 있는 내부 또는 미러 레지스트리에 대한 연결이 필요합니다.

- 베어 메탈 프로비저닝에 필요한 포트를 열어야 합니다. OpenShift Container Platform 설명서에서 필요한 포트 활성화를 참조하십시오.

- 베어 메탈 호스트 사용자 정의 리소스 정의가 필요합니다.

- OpenShift Container Platform 풀 시크릿 이 필요합니다. 자세한 내용은 이미지 풀 시크릿 사용을 참조하십시오.

- 구성된 기본 스토리지 클래스가 필요합니다.

- 연결이 끊긴 환경의 경우 OpenShift Container Platform 설명서에서 네트워크 맨 엣지에서 클러스터에 대한 절차를 완료합니다.

1.5.3.1.2. 베어 메탈 호스트 사용자 정의 리소스 정의 생성

중앙 인프라 관리 서비스를 활성화하기 전에 베어 메탈 호스트 사용자 정의 리소스 정의가 필요합니다.

다음 명령을 실행하여 베어 메탈 호스트 사용자 정의 리소스 정의가 있는지 확인합니다.

oc get crd baremetalhosts.metal3.io- 베어 메탈 호스트 사용자 정의 리소스 정의가 있는 경우 출력에 리소스가 생성된 날짜가 표시됩니다.

리소스가 없는 경우 다음과 유사한 오류가 표시됩니다.

Error from server (NotFound): customresourcedefinitions.apiextensions.k8s.io "baremetalhosts.metal3.io" not found

베어 메탈 호스트 사용자 정의 리소스 정의가 없는 경우 metal3.io_baremetalhosts.yaml 파일을 다운로드하고 다음 명령을 실행하여 리소스를 생성하여 콘텐츠를 적용합니다.

oc apply -f

1.5.3.1.3. 프로비저닝 리소스 생성 또는 수정

중앙 인프라 관리 서비스를 활성화하려면 프로비저닝 리소스가 필요합니다.

다음 명령을 실행하여

프로비저닝리소스가 있는지 확인합니다.oc get provisioning-

프로비저닝 리소스가 이미 있는 경우

프로비저닝리소스 를 계속 수정합니다. -

프로비저닝리소스가 없는 경우 리소스를 찾을 수 없음오류가 표시됩니다.프로비저닝리소스 생성을 계속합니다.

-

프로비저닝 리소스가 이미 있는 경우

1.5.3.1.3.1. 프로비저닝 리소스 수정

프로비저닝 리소스가 이미 있는 경우 hub 클러스터가 다음 플랫폼 중 하나에 설치된 경우 리소스를 수정해야 합니다.

- 베어 메탈

- Red Hat OpenStack Platform

- VMware vSphere

-

사용자 프로비저닝 인프라(UPI) 방법 및 플랫폼은

None입니다.

허브 클러스터가 다른 플랫폼에 설치된 경우 연결이 끊긴 환경에서 중앙 인프라 관리 활성화 또는 연결된 환경에서 중앙 인프라 관리 활성화에서 계속 진행하십시오.

다음 명령을 실행하여 Bare Metal Operator가 모든 네임스페이스를 조사할 수 있도록

프로비저닝리소스를 수정합니다.oc patch provisioning provisioning-configuration --type merge -p '{"spec":{"watchAllNamespaces": true }}'

1.5.3.1.3.2. 프로비저닝 리소스 생성

프로비저닝 리소스가 없는 경우 다음 단계를 완료합니다.

다음 YAML 콘텐츠를 추가하여

프로비저닝리소스를 생성합니다.apiVersion: metal3.io/v1alpha1 kind: Provisioning metadata: name: provisioning-configuration spec: provisioningNetwork: "Disabled" watchAllNamespaces: true다음 명령을 실행하여 콘텐츠를 적용합니다.

oc apply -f

1.5.3.1.4. 연결이 끊긴 환경에서 중앙 인프라 관리 활성화

연결이 끊긴 환경에서 중앙 인프라 관리를 활성화하려면 다음 단계를 완료합니다.

인프라 Operator와 동일한 네임스페이스에

ConfigMap을 생성하여 미러 레지스트리의ca-bundle.crt및registries.conf값을 지정합니다. 파일ConfigMap은 다음 예와 유사할 수 있습니다.apiVersion: v1 kind: ConfigMap metadata: name: <mirror-config> namespace: multicluster-engine labels: app: assisted-service data: ca-bundle.crt: | <certificate-content> registries.conf: | unqualified-search-registries = ["registry.access.redhat.com", "docker.io"] [[registry]] prefix = "" location = "registry.redhat.io/multicluster-engine" mirror-by-digest-only = true [[registry.mirror]] location = "mirror.registry.com:5000/multicluster-engine"참고: 다이제스트를 사용하여 릴리스 이미지가 지정되므로

mirror-by-digest-only를true로 설정해야 합니다.unqualified-search-registries목록의 레지스트리는PUBLIC_CONTAINER_REGISTRIES환경 변수의 인증 무시 목록에 자동으로 추가됩니다. 관리 클러스터의 풀 시크릿을 검증할 때 지정된 레지스트리는 인증이 필요하지 않습니다.-

모든

osImage요청과 함께 보낼 헤더 및 쿼리 매개변수를 나타내는 키 쌍을 작성합니다. 두 매개변수가 모두 필요하지 않은 경우 헤더 또는 쿼리 매개변수에만 대한 키 쌍을 작성합니다.

중요: 헤더 및 쿼리 매개변수는 HTTPS를 사용하는 경우에만 암호화됩니다. 보안 문제를 방지하려면 HTTPS를 사용해야 합니다.

headers라는 파일을 생성하고 다음 예제와 유사한 콘텐츠를 추가합니다.{ "Authorization": "Basic xyz" }query_params라는 파일을 생성하고 다음 예와 유사한 콘텐츠를 추가합니다.{ "api_key": "myexampleapikey", }다음 명령을 실행하여 생성한 매개변수 파일에서 시크릿을 생성합니다. 하나의 매개변수 파일만 생성한 경우 생성하지 않은 파일의 인수를 제거합니다.

oc create secret generic -n multicluster-engine os-images-http-auth --from-file=./query_params --from-file=./headers자체 서명 또는 타사 CA 인증서와 함께 HTTPS

osImages를 사용하려면image-service-additional-caConfigMap에 인증서를 추가합니다. 인증서를 생성하려면 다음 명령을 실행합니다.oc -n multicluster-engine create configmap image-service-additional-ca --from-file=tls.crtagent_service_config.yaml파일에 다음 YAML 콘텐츠를 저장하여AgentServiceConfig사용자 지정 리소스를 생성합니다.apiVersion: agent-install.openshift.io/v1beta1 kind: AgentServiceConfig metadata: name: agent spec: databaseStorage: accessModes: - ReadWriteOnce resources: requests: storage: <db_volume_size> filesystemStorage: accessModes: - ReadWriteOnce resources: requests: storage: <fs_volume_size> mirrorRegistryRef: name: <mirror_config>1 unauthenticatedRegistries: - <unauthenticated_registry>2 imageStorage: accessModes: - ReadWriteOnce resources: requests: storage: <img_volume_size>3 OSImageAdditionalParamsRef: name: os-images-http-auth OSImageCACertRef: name: image-service-additional-ca osImages: - openshiftVersion: "<ocp_version>"4 version: "<ocp_release_version>"5 url: "<iso_url>"6 cpuArchitecture: "x86_64"- 1 1

mirror_config를 미러 레지스트리 구성 세부 정보가 포함된ConfigMap의 이름으로 교체합니다.- 2

- 인증이 필요하지 않은 미러 레지스트리를 사용하는 경우 선택적

unauthenticated_registry매개변수를 포함합니다. 이 목록의 항목은 검증되지 않았거나 풀 시크릿에 항목이 있어야 합니다. - 3

img_volume_size를imageStorage필드의 볼륨 크기로 바꿉니다(예: 운영 체제 이미지당10Gi). 최소 값은10Gi이지만 권장 값은 최소50Gi입니다. 이 값은 클러스터 이미지에 할당된 스토리지 양을 지정합니다. 실행 중인 Red Hat Enterprise Linux CoreOS의 각 인스턴스에 대해 1GB의 이미지 스토리지를 허용해야 합니다. Red Hat Enterprise Linux CoreOS 클러스터 및 인스턴스가 많은 경우 더 높은 값을 사용해야 할 수 있습니다.- 4

ocp_version을 설치할 OpenShift Container Platform 버전으로 교체합니다(예:4.13).- 5

ocp_release_version을 특정 설치 버전 (예:49.83.202103251640-0)으로 바꿉니다.- 6

iso_url을 ISO URL로 바꿉니다(예:https://mirror.openshift.com/pub/openshift-v4/x86_64/dependencies/rhcos/4.13/4.13.3/rhcos-4.13.3-x86_64-live.x86_64.iso). 다른 값은 4.12.3 종속 항목에서 찾을 수 있습니다.

자체 서명 또는 타사 CA 인증서가 있는 HTTPS osImages 를 사용하는 경우 OSImageCACertRef 사양의 인증서를 참조하십시오.

중요: AgentServiceConfig 사용자 정의 리소스의 spec.osImages 릴리스를 버전 4.13 이상인 경우 클러스터를 생성할 때 사용하는 OpenShift Container Platform 릴리스 이미지는 버전 4.13 이상이어야 합니다. 버전 4.13 이상용 Red Hat Enterprise Linux CoreOS 이미지는 버전 4.13 이전의 이미지와 호환되지 않습니다.

assisted-service 및 assisted-image-service 배포를 확인하고 Pod가 준비되어 실행 중인지 확인하여 중앙 인프라 관리 서비스가 정상인지 확인할 수 있습니다.

1.5.3.1.5. 연결된 환경에서 중앙 인프라 관리 활성화

연결된 환경에서 중앙 인프라 관리를 활성화하려면 agent_service_config.yaml 파일에 다음 YAML 콘텐츠를 저장하여 AgentServiceConfig 사용자 지정 리소스를 생성합니다.

apiVersion: agent-install.openshift.io/v1beta1

kind: AgentServiceConfig

metadata:

name: agent

spec:

databaseStorage:

accessModes:

- ReadWriteOnce

resources:

requests:

storage: <db_volume_size>

filesystemStorage:

accessModes:

- ReadWriteOnce

resources:

requests:

storage: <fs_volume_size>

imageStorage:

accessModes:

- ReadWriteOnce

resources:

requests:

storage: <img_volume_size> - 1

db_volume_size를databaseStorage필드의 볼륨 크기(예:10Gi)로 바꿉니다. 이 값은 클러스터의 데이터베이스 테이블 및 데이터베이스 뷰와 같은 파일을 저장하기 위해 할당된 스토리지 양을 지정합니다. 필요한 최소 값은1Gi입니다. 클러스터가 여러 개인 경우 더 높은 값을 사용해야 할 수 있습니다.- 2

fs_volume_size를filesystemStorage필드의 볼륨 크기로 바꿉니다(예: 클러스터당200M, 지원되는 OpenShift Container Platform 버전당2-3Gi). 필요한 최소 값은1Gi이지만 권장 값은100Gi이상이어야 합니다. 이 값은 클러스터의 로그, 매니페스트 및kubeconfig파일을 저장하기 위해 할당된 스토리지 양을 지정합니다. 클러스터가 여러 개인 경우 더 높은 값을 사용해야 할 수 있습니다.- 3

img_volume_size를imageStorage필드의 볼륨 크기로 바꿉니다(예: 운영 체제 이미지당10Gi). 최소 값은10Gi이지만 권장 값은 최소50Gi입니다. 이 값은 클러스터 이미지에 할당된 스토리지 양을 지정합니다. 실행 중인 Red Hat Enterprise Linux CoreOS의 각 인스턴스에 대해 1GB의 이미지 스토리지를 허용해야 합니다. Red Hat Enterprise Linux CoreOS 클러스터 및 인스턴스가 많은 경우 더 높은 값을 사용해야 할 수 있습니다.

중앙 인프라 관리 서비스가 구성되어 있습니다. assisted-service 및 assisted-image-service 배포를 확인하고 Pod가 준비되고 실행 중인지 확인하여 정상 상태인지 확인할 수 있습니다.

1.5.3.1.6. 추가 리소스

- 제로 터치 프로비저닝에 대한 자세한 내용은 OpenShift Container Platform 설명서 의 네트워크 맨 위에 있는 클러스터를 참조하십시오.

- 이미지 풀 시크릿 사용을참조하십시오.

1.5.3.2. Amazon Web Services에서 중앙 인프라 관리 활성화

Amazon Web Services에서 Hub 클러스터를 실행하고 중앙 인프라 관리 서비스를 활성화하려면 중앙 인프라 관리 서비스를 활성화한 후 다음 단계를 완료합니다.

hub 클러스터에 로그인했는지 확인하고 다음 명령을 실행하여

assisted-image-service에 구성된 고유한 도메인을 찾습니다.oc get routes --all-namespaces | grep assisted-image-service도메인은 다음 예와 유사할 수 있습니다.

assisted-image-service-multicluster-engine.apps.<yourdomain>.comhub 클러스터에 로그인했는지 확인하고

NLBtype매개변수를 사용하여 고유한 도메인으로 새IngressController를 생성합니다. 다음 예제를 참조하십시오.apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: ingress-controller-with-nlb namespace: openshift-ingress-operator spec: domain: nlb-apps.<domain>.com routeSelector: matchLabels: router-type: nlb endpointPublishingStrategy: type: LoadBalancerService loadBalancer: scope: External providerParameters: type: AWS aws: type: NLB-

nlb-apps.<매개변수에 <domain>.com에서 <yourdomain>을 <yourdomain>으로 교체하여IngressController의 domainyourdomain>을 추가합니다. 다음 명령을 실행하여 새

IngressController를 적용합니다.oc apply -f ingresscontroller.yaml다음 단계를 완료하여 새

IngressController의spec.domain매개변수 값이 기존IngressController와 충돌하지 않는지 확인합니다.다음 명령을 실행하여 모든

IngressController를 나열합니다.oc get ingresscontroller -n openshift-ingress-operator방금 생성한

ingress-controller-with-nlb를 제외하고 각IngressController에서 다음 명령을 실행합니다.oc edit ingresscontroller <name> -n openshift-ingress-operatorspec.domain보고서가 없는 경우nlb-apps.<domain>.com을 제외한 클러스터에 노출된 모든 경로와 일치하는 기본 도메인을 추가합니다.spec.domain보고서가 제공된 경우nlb-apps.<domain>.com경로가 지정된 범위에서 제외되었는지 확인합니다.

다음 명령을 실행하여

nlb-apps위치를 사용하도록assisted-image-service경로를 편집합니다.oc edit route assisted-image-service -n <namespace>기본 네임스페이스는 다중 클러스터 엔진 Operator를 설치한 위치입니다.

assisted-image-service경로에 다음 행을 추가합니다.metadata: labels: router-type: nlb name: assisted-image-serviceassisted-image-service경로에서spec.host의 URL 값을 찾습니다. URL은 다음 예와 유사할 수 있습니다.assisted-image-service-multicluster-engine.apps.<yourdomain>.com-

새

IngressController에 구성된 도메인과 일치하도록 URL의 앱을nlb-로 교체합니다.apps Amazon Web Services에서 중앙 인프라 관리 서비스가 활성화되어 있는지 확인하려면 다음 명령을 실행하여 Pod가 정상 상태인지 확인합니다.

oc get pods -n multicluster-engine | grep assist-

새 호스트 인벤토리를 생성하고 다운로드 URL이 새

nlb-appsURL을 사용하는지 확인합니다.

1.5.3.3. 콘솔을 사용하여 호스트 인벤토리 생성

호스트 인벤토리(인프라 환경)를 생성하여 OpenShift Container Platform 클러스터를 설치할 수 있는 물리적 또는 가상 머신을 검색할 수 있습니다.

1.5.3.3.1. 사전 요구 사항

- 중앙 인프라 관리 서비스를 활성화해야 합니다. 자세한 내용은 중앙 인프라 관리 서비스 활성화를 참조하십시오.

1.5.3.3.2. 호스트 인벤토리 생성

콘솔을 사용하여 호스트 인벤토리를 생성하려면 다음 단계를 완료합니다.

- 콘솔에서 인프라 > 호스트 인벤토리 로 이동하여 인프라 환경 생성 을 클릭합니다.

호스트 인벤토리 설정에 다음 정보를 추가합니다.

-

이름: 인프라 환경의 고유 이름입니다. 콘솔을 사용하여 인프라 환경을 생성하면 선택한 이름으로

InfraEnv리소스의 새 네임스페이스도 생성됩니다. 명령줄 인터페이스를 사용하여InfraEnv리소스를 생성하고 콘솔에서 리소스를 모니터링하려면 네임스페이스와InfraEnv에 동일한 이름을 사용합니다. - 네트워크 유형: 인프라 환경에 추가하는 호스트가 DHCP 또는 정적 네트워킹을 사용하는지 여부를 지정합니다. 정적 네트워킹 구성에는 추가 단계가 필요합니다.

- Location: 호스트의 지리적 위치를 지정합니다. 지리적 위치는 호스트가 있는 데이터 센터를 정의하는 데 사용할 수 있습니다.

- labels: 이 인프라 환경에서 검색된 호스트에 레이블을 추가할 수 있는 선택적 필드입니다. 지정된 위치가 레이블 목록에 자동으로 추가됩니다.

- 인프라 공급자 인증 정보: 인프라 공급자 인증 정보를 선택하면 풀 시크릿 및 SSH 공개 키 필드가 인증 정보에 자동으로 채워집니다. 자세한 내용은 온-프레미스 환경에 대한 인증 정보 만들기 를 참조하십시오.

- 풀 시크릿: OpenShift Container Platform 리소스에 액세스할 수 있는 OpenShift Container Platform 풀 시크릿 입니다. 인프라 공급자 인증 정보를 선택한 경우 이 필드가 자동으로 채워집니다.

-

SSH 공개 키: 호스트와의 보안 통신을 활성화하는 SSH 키입니다. 문제 해결을 위해 호스트에 연결하는 데 사용할 수 있습니다. 클러스터를 설치한 후에는 더 이상 SSH 키를 사용하여 호스트에 연결할 수 없습니다. 키는 일반적으로

id_rsa.pub파일에 있습니다. 기본 파일 경로는~/.ssh/id_rsa.pub입니다. SSH 공개 키 값이 포함된 인프라 공급자 인증 정보를 선택한 경우 이 필드가 자동으로 채워집니다. 호스트에 프록시 설정을 활성화하려면 활성화할 설정을 선택하고 다음 정보를 입력합니다.

- HTTP 프록시 URL: HTTP 요청에 대한 프록시의 URL입니다.

- HTTPS 프록시 URL: HTTP 요청에 대한 프록시의 URL입니다. URL은 HTTP로 시작해야 합니다. HTTPS는 지원되지 않습니다. 값을 지정하지 않으면 HTTP 프록시 URL이 기본적으로 HTTP 및 HTTPS 연결에 사용됩니다.

-

프록시 도메인 없음: 프록시를 사용하지 않으려는 쉼표로 구분된 도메인 목록입니다. 마침표(

.)로 도메인 이름을 시작하여 해당 도메인에 있는 모든 하위 도메인을 포함합니다. 모든 대상에 대해 프록시를 바이패스하려면 별표(*)를 추가합니다.

- 선택적으로 NTP 풀 또는 서버의 쉼표로 구분된 IP 또는 도메인 이름 목록을 제공하여 고유한 NTP(Network Time Protocol) 소스를 추가합니다.

-

이름: 인프라 환경의 고유 이름입니다. 콘솔을 사용하여 인프라 환경을 생성하면 선택한 이름으로

콘솔에서 사용할 수 없는 고급 구성 옵션이 필요한 경우 명령줄 인터페이스를 사용하여 호스트 인벤토리 생성을 계속합니다.

고급 구성 옵션이 필요하지 않은 경우 정적 네트워킹을 구성하여 계속해서 인프라 환경에 호스트를 추가할 수 있습니다.

1.5.3.3.3. 호스트 인벤토리에 액세스

호스트 인벤토리에 액세스하려면 콘솔에서 인프라 > 호스트 인벤토리 를 선택합니다. 목록에서 인프라 환경을 선택하여 세부 정보 및 호스트를 확인합니다.

1.5.3.3.4. 추가 리소스

- 중앙 인프라 관리 서비스 활성화를참조하십시오.

- 온-프레미스 환경에 대한 인증 정보 생성을 참조하십시오.

- 명령줄 인터페이스를 사용하여 호스트 인벤토리 생성을참조하십시오.

베어 메탈에서 호스팅된 컨트롤 플레인을 구성하는 프로세스의 일부로 이 절차를 완료한 경우 다음 절차를 완료하는 것입니다.

1.5.3.4. 명령줄 인터페이스를 사용하여 호스트 인벤토리 생성

호스트 인벤토리(인프라 환경)를 생성하여 OpenShift Container Platform 클러스터를 설치할 수 있는 물리적 또는 가상 머신을 검색할 수 있습니다. 자동화된 배포 또는 다음 고급 구성 옵션에는 콘솔 대신 명령줄 인터페이스를 사용합니다.

- 검색된 호스트를 기존 클러스터 정의에 자동으로 바인딩

- Discovery Image의 ignition 구성 덮어쓰기

- iPXE 동작 제어

- Discovery Image의 커널 인수 수정

- 검색 단계에서 호스트가 신뢰할 수 있는 추가 인증서 전달

- 최신 버전의 기본 옵션이 아닌 테스트를 위해 부팅할 Red Hat CoreOS 버전을 선택합니다.

1.5.3.4.1. 사전 요구 사항

- 중앙 인프라 관리 서비스를 활성화해야 합니다. 자세한 내용은 중앙 인프라 관리 서비스 활성화를 참조하십시오.

1.5.3.4.2. 호스트 인벤토리 생성

명령줄 인터페이스를 사용하여 호스트 인벤토리(인프라 환경)를 생성하려면 다음 단계를 완료합니다.

다음 명령을 실행하여 허브 클러스터에 로그인합니다.

oc login리소스의 네임스페이스를 생성합니다.

namespace.yaml파일을 생성하고 다음 콘텐츠를 추가합니다.apiVersion: v1 kind: Namespace metadata: name: <your_namespace>1 - 1

- 네임스페이스에서 동일한 이름을 사용하여 콘솔에서 인벤토리를 모니터링합니다.

다음 명령을 실행하여 YAML 콘텐츠를 적용합니다.

oc apply -f namespace.yaml

OpenShift Container Platform 풀 보안이 포함된

Secret사용자 정의 리소스를 생성합니다.pull-secret.yaml파일을 생성하고 다음 콘텐츠를 추가합니다.apiVersion: v1 kind: Secret type: kubernetes.io/dockerconfigjson metadata: name: pull-secret1 namespace: <your_namespace> stringData: .dockerconfigjson: <your_pull_secret>2 다음 명령을 실행하여 YAML 콘텐츠를 적용합니다.

oc apply -f pull-secret.yaml

인프라 환경을 생성합니다.

infra-env.yaml파일을 생성하고 다음 콘텐츠를 추가합니다. 필요한 경우 값을 바꿉니다.apiVersion: agent-install.openshift.io/v1beta1 kind: InfraEnv metadata: name: myinfraenv namespace: <your_namespace> spec: proxy: httpProxy: <http://user:password@ipaddr:port> httpsProxy: <http://user:password@ipaddr:port> noProxy: additionalNTPSources: sshAuthorizedKey: pullSecretRef: name: <name> agentLabels: <key>: <value> nmStateConfigLabelSelector: matchLabels: <key>: <value> clusterRef: name: <cluster_name> namespace: <project_name> ignitionConfigOverride: '{"ignition": {"version": "3.1.0"}, …}' cpuArchitecture: x86_64 ipxeScriptType: DiscoveryImageAlways kernelArguments: - operation: append value: audit=0 additionalTrustBundle: <bundle> osImageVersion: <version>

| 필드 | 선택 사항 또는 필수 | 설명 |

|---|---|---|

|

| 선택 사항 |

|

|

| 선택 사항 |

HTTP 요청에 대한 프록시의 URL입니다. URL은 |

|

| 선택 사항 |

HTTP 요청에 대한 프록시의 URL입니다. URL은 |

|

| 선택 사항 | 프록시를 사용하지 않으려는 쉼표로 구분된 도메인 및 CIDR 목록입니다. |

|

| 선택 사항 | 모든 호스트에 추가할 NTP(Network Time Protocol) 소스(hostname 또는 IP) 목록입니다. DHCP와 같은 다른 옵션을 사용하여 구성된 NTP 소스에 추가됩니다. |

|

| 선택 사항 | 검색 단계에서 디버깅에 사용할 수 있도록 모든 호스트에 추가된 SSH 공개 키입니다. 검색 단계는 호스트가 검색 이미지를 부팅하는 단계입니다. |

|

| 필수 항목 | 풀 보안이 포함된 Kubernetes 시크릿의 이름입니다. |

|

| 선택 사항 |

|

|

| 선택 사항 |

호스트의 고정 IP, 브리지 및 본딩과 같은 고급 네트워크 구성을 통합합니다. 호스트 네트워크 구성은 선택한 라벨을 사용하여 하나 이상의 |

|

| 선택 사항 |

독립 실행형 온-프레미스 클러스터를 설명하는 기존 |

|

| 선택 사항 |

Red Hat CoreOS 라이브 이미지의 ignition 구성(예: 파일 추가)을 수정합니다. 필요한 경우에만 |

|

| 선택 사항 | 지원되는 CPU 아키텍처(x86_64, aarch64, ppc64le 또는 s390x) 중 하나를 선택합니다. 기본값은 x86_64입니다. |

|

| 선택 사항 |

|

|

| 선택 사항 |

Discovery Image가 부팅될 때 에 대한 커널 인수를 수정할 수 있습니다. |

|

| 선택 사항 |

PEM 인코딩 X.509 인증서 번들, 일반적으로 호스트가 다시 암호화하는 MITTM(man-in-the-middle) 프록시가 있는 네트워크에 있거나 호스트가 컨테이너 이미지 레지스트리와 같은 다른 목적으로 인증서를 신뢰해야 하는 경우 필요합니다. |

|

| 선택 사항 |

|

다음 명령을 실행하여 YAML 콘텐츠를 적용합니다.

oc apply -f infra-env.yaml호스트 인벤토리가 생성되었는지 확인하려면 다음 명령을 사용하여 상태를 확인합니다.

oc describe infraenv myinfraenv -n <your_namespace>

다음 주요 속성 목록을 참조하십시오.

-

conditions: 이미지가 성공적으로 생성되었는지를 나타내는 표준 Kubernetes 상태입니다. -

isoDownloadURL: Discovery Image를 다운로드할 URL입니다. -

createdTime: 이미지가 마지막으로 생성된 시간입니다.InfraEnv를 수정하는 경우 새 이미지를 다운로드하기 전에 타임스탬프가 업데이트되었는지 확인합니다.

참고: InfraEnv 리소스를 수정하는 경우, createdTime 속성을 확인하여 InfraEnv 에서 새 Discovery Image를 생성했는지 확인합니다. 이미 호스트를 부팅한 경우 최신 Discovery Image를 사용하여 다시 부팅합니다.

필요한 경우 정적 네트워킹을 구성하고 인프라 환경에 호스트를 추가할 수 있습니다.

1.5.3.4.3. 추가 리소스

- 중앙 인프라 관리 서비스 활성화를 참조하십시오.

1.5.3.5. 인프라 환경에 대한 고급 네트워킹 구성

단일 인터페이스에서 DHCP 이외의 네트워킹이 필요한 호스트의 경우 고급 네트워킹을 구성해야 합니다. 필수 구성에는 하나 이상의 호스트에 대한 네트워킹을 설명하는 NMStateConfig 리소스의 인스턴스 생성이 포함됩니다.

각 NMStateConfig 리소스에는 InfraEnv 리소스의 nmStateConfigLabelSelector 와 일치하는 레이블이 포함되어야 합니다. nmStateConfigLabelSelector 에 대한 자세한 내용은 명령줄 인터페이스를 사용하여 호스트 인벤토리 생성 을 참조하십시오.

Discovery Image에는 참조된 모든 NMStateConfig 리소스에 정의된 네트워크 구성이 포함되어 있습니다. 부팅 후 각 호스트는 각 구성을 네트워크 인터페이스와 비교하고 적절한 구성을 적용합니다.

1.5.3.5.1. 사전 요구 사항

- 중앙 인프라 관리 서비스를 활성화해야 합니다.

- 호스트 인벤토리를 생성해야 합니다.

1.5.3.5.2. 명령줄 인터페이스를 사용하여 고급 네트워킹 구성

명령줄 인터페이스를 사용하여 인프라 환경에 대한 고급 네트워킹을 구성하려면 다음 단계를 완료합니다.

nmstateconfig.yaml이라는 파일을 생성하고 다음 템플릿과 유사한 콘텐츠를 추가합니다. 필요한 경우 값을 바꿉니다.apiVersion: agent-install.openshift.io/v1beta1 kind: NMStateConfig metadata: name: mynmstateconfig namespace: <your-infraenv-namespace> labels: some-key: <some-value> spec: config: interfaces: - name: eth0 type: ethernet state: up mac-address: 02:00:00:80:12:14 ipv4: enabled: true address: - ip: 192.168.111.30 prefix-length: 24 dhcp: false - name: eth1 type: ethernet state: up mac-address: 02:00:00:80:12:15 ipv4: enabled: true address: - ip: 192.168.140.30 prefix-length: 24 dhcp: false dns-resolver: config: server: - 192.168.126.1 routes: config: - destination: 0.0.0.0/0 next-hop-address: 192.168.111.1 next-hop-interface: eth1 table-id: 254 - destination: 0.0.0.0/0 next-hop-address: 192.168.140.1 next-hop-interface: eth1 table-id: 254 interfaces: - name: "eth0" macAddress: "02:00:00:80:12:14" - name: "eth1" macAddress: "02:00:00:80:12:15"

| 필드 | 선택 사항 또는 필수 | 설명 |

|---|---|---|

|

| 필수 항목 | 구성 중인 호스트 또는 호스트와 관련된 이름을 사용합니다. |

|

| 필수 항목 |

네임스페이스는 |

|

| 필수 항목 |

|

|

| 선택 사항 |

|

|

| 선택 사항 |

지정된 |

참고: 이미지 서비스는 InfraEnv 속성을 업데이트하거나 레이블 선택기와 일치하는 NMStateConfig 리소스를 변경할 때 새 이미지를 자동으로 생성합니다. 리소스를 생성한 후 InfraEnv NMStateConfig 리소스를 추가하는 경우 InfraEnv에서 InfraEnv 에서 createdTime 속성을 확인하여 새 Discovery Image를 생성해야 합니다. 이미 호스트를 부팅한 경우 최신 Discovery Image를 사용하여 다시 부팅합니다.

다음 명령을 실행하여 YAML 콘텐츠를 적용합니다.

oc apply -f nmstateconfig.yaml

1.5.3.5.3. 추가 리소스

- 명령줄 인터페이스를 사용하여 호스트 인벤토리 생성을참조하십시오.

- 선언 네트워크 API참조

1.5.3.6. Discovery Image를 사용하여 호스트 인벤토리에 호스트 추가

호스트 인벤토리(인프라 환경)를 생성한 후 호스트를 검색하여 인벤토리에 추가할 수 있습니다. 인벤토리에 호스트를 추가하려면 ISO를 다운로드하여 각 서버에 연결할 방법을 선택합니다. 예를 들어 가상 미디어를 사용하거나 USB 드라이브에 ISO를 작성하여 ISO를 다운로드할 수 있습니다.

중요: 설치에 실패하지 않도록 설치 프로세스 중에 장치에 Discovery ISO 미디어를 계속 연결하고 각 호스트를 한 번에 부팅하도록 설정합니다.

1.5.3.6.1. 사전 요구 사항

- 중앙 인프라 관리 서비스를 활성화해야 합니다. 자세한 내용은 중앙 인프라 관리 서비스 활성화를 참조하십시오.

- 호스트 인벤토리를 생성해야 합니다. 자세한 내용은 콘솔을 사용하여 호스트 인벤토리 생성 을 참조하십시오.

1.5.3.6.2. 콘솔을 사용하여 호스트 추가

다음 단계를 완료하여 ISO를 다운로드합니다.

- 콘솔에서 Infrastructure > Host inventory 를 선택합니다.

- 목록에서 인프라 환경을 선택합니다.

- 호스트 추가를 클릭하고 Discovery ISO 사용을 선택합니다.

이제 ISO를 다운로드할 URL이 표시됩니다. 부팅된 호스트가 호스트 인벤토리 테이블에 나타납니다. 호스트가 표시되는 데 몇 분이 걸릴 수 있습니다. 각 호스트를 사용하려면 먼저 승인해야 합니다. 작업을 클릭하고 승인을 선택하여 인벤토리 테이블에서 호스트를 선택할 수 있습니다.

1.5.3.6.3. 명령줄 인터페이스를 사용하여 호스트 추가

InfraEnv 리소스의 상태에서 isoDownloadURL 속성에서 ISO를 다운로드하는 URL을 볼 수 있습니다. InfraEnv 리소스에 대한 자세한 내용은 명령줄 인터페이스를 사용하여 호스트 인벤토리 생성을 참조하십시오.

부팅된 각 호스트는 동일한 네임스페이스에 에이전트 리소스를 생성합니다. 각 호스트를 사용하려면 먼저 승인해야 합니다.

1.5.3.6.4. 추가 리소스

- 중앙 인프라 관리 서비스 활성화를참조하십시오.

- 콘솔을 사용하여 호스트 인벤토리 생성을참조하십시오.

- 명령줄 인터페이스를 사용하여 호스트 인벤토리 생성을참조하십시오.

1.5.3.7. 호스트 인벤토리에 베어 메탈 호스트 자동 추가

호스트 인벤토리(인프라 환경)를 생성한 후 호스트를 검색하여 인벤토리에 추가할 수 있습니다. 베어 메탈 Operator가 각 베어 메탈 호스트의 BMC(Baseboard Management Controller)와 각 호스트에 대해 BareMetalHost 리소스 및 관련 BMC 시크릿을 생성하여 인프라 환경의 검색 이미지 부팅을 자동화할 수 있습니다. 자동화는 인프라 환경을 참조하는 BareMetalHost 의 레이블로 설정됩니다.

자동화는 다음 작업을 수행합니다.

- 인프라 환경에서 표시하는 Discovery Image를 사용하여 각 베어 메탈 호스트 부팅

- 인프라 환경 또는 관련 네트워크 구성이 업데이트되는 경우 각 호스트를 최신 검색 이미지로 재부팅

-

검색 시 각

에이전트리소스를 해당BareMetalHost리소스와 연결합니다. -

호스트 이름, 역할 및 설치 디스크와 같은

BareMetalHost의 정보를 기반으로에이전트리소스 속성 업데이트 -

클러스터 노드로 사용할

에이전트승인

1.5.3.7.1. 사전 요구 사항

- 중앙 인프라 관리 서비스를 활성화해야 합니다.

- 호스트 인벤토리를 생성해야 합니다.

1.5.3.7.2. 콘솔을 사용하여 베어 메탈 호스트 추가

콘솔을 사용하여 호스트 인벤토리에 베어 메탈 호스트를 자동으로 추가하려면 다음 단계를 완료합니다.

- 콘솔에서 Infrastructure > Host inventory 를 선택합니다.

- 목록에서 인프라 환경을 선택합니다.

- 호스트 추가를 클릭하고 BMC 양식으로 를 선택합니다.

- 필요한 정보를 추가하고 생성 을 클릭합니다.

BMC 주소 지정에 대한 자세한 내용은 추가 리소스 섹션의 BMC 주소 지정을 참조하십시오.

1.5.3.7.3. 명령줄 인터페이스를 사용하여 베어 메탈 호스트 추가

명령줄 인터페이스를 사용하여 호스트 인벤토리에 베어 메탈 호스트를 자동으로 추가하려면 다음 단계를 완료합니다.

다음 YAML 콘텐츠를 적용하고 필요한 경우 값을 교체하여 BMC 시크릿을 생성합니다.

apiVersion: v1 kind: Secret metadata: name: <bmc-secret-name> namespace: <your_infraenv_namespace>1 type: Opaque data: username: <username> password: <password>- 1

- 네임스페이스는

InfraEnv의 네임스페이스와 동일해야 합니다.

다음 YAML 콘텐츠를 적용하고 필요한 경우 값을 교체하여 베어 메탈 호스트를 생성합니다.

apiVersion: metal3.io/v1alpha1 kind: BareMetalHost metadata: name: <bmh-name> namespace: <your-infraenv-namespace>1 annotations: inspect.metal3.io: disabled bmac.agent-install.openshift.io/hostname: <hostname>2 bmac.agent-install.openshift.io/role: <role>3 labels: infraenvs.agent-install.openshift.io: <your-infraenv>4 spec: online: true automatedCleaningMode: disabled5 bootMACAddress: <your-mac-address>6 bmc: address: <machine-address>7 credentialsName: <bmc-secret-name>8 rootDeviceHints: deviceName: /dev/sda9 - 1

- 네임스페이스는

InfraEnv의 네임스페이스와 동일해야 합니다. - 2

- 선택 사항: 호스트 이름으로 바꿉니다.

- 3

- 선택 사항: 가능한 값은

master또는worker입니다. - 4

- 이름은

InfrEnv의 이름과 일치해야 하며 동일한 네임스페이스에 있어야 합니다. - 5

- 값을 설정하지 않으면

메타데이터값이 자동으로 사용됩니다. - 6

- MAC 주소가 호스트 인터페이스 중 하나의 MAC 주소와 일치하는지 확인합니다.

- 7

- BMC 주소를 사용합니다. 자세한 내용은 추가 리소스 섹션의 대역 외 관리 IP 주소에 대한 포트 액세스 및 BMC 주소 지정을 참조하십시오.

- 8

credentialsName값이 생성한 BMC 시크릿의 이름과 일치하는지 확인합니다.- 9

- 선택 사항: 설치 디스크를 선택합니다. 사용 가능한 루트 장치 팁은 BareMetalHost 사양 을 참조하십시오. 호스트를 검색 이미지로 부팅하고 해당

에이전트리소스가 생성되면 이 팁에 따라 설치 디스크가 설정됩니다.

호스트를 켜면 이미지가 다운로드되기 시작합니다. 이 작업은 몇 분 정도 걸릴 수 있습니다. 호스트가 검색되면 에이전트 사용자 지정 리소스가 자동으로 생성됩니다.

1.5.3.7.4. 통합 흐름 비활성화

통합 흐름은 기본적으로 활성화되어 있습니다. 호스트가 나타나지 않으면 통합 흐름을 일시적으로 비활성화해야 할 수 있습니다. 통합 흐름을 비활성화하려면 다음 단계를 완료합니다.

허브 클러스터에 다음 구성 맵을 생성합니다.

apiVersion: v1 kind: ConfigMap metadata: name: my-assisted-service-config namespace: multicluster-engine data: ALLOW_CONVERGED_FLOW: "false"참고:

ALLOW_CONVERGED_FLOW를"false"로 설정하면 Ironic Python 에이전트에서 활성화한 모든 기능도 비활성화합니다.다음 명령을 실행하여 구성 맵을 적용합니다.

oc annotate --overwrite AgentServiceConfig agent unsupported.agent-install.openshift.io/assisted-service-configmap=my-assisted-service-config

1.5.3.7.5. 명령줄 인터페이스를 사용하여 관리형 클러스터 노드 제거

관리형 클러스터에서 관리형 클러스터 노드를 제거하려면 OpenShift Container Platform 버전 4.13 이상을 실행 중인 허브 클러스터가 필요합니다. 노드를 부팅하는 데 필요한 정적 네트워킹 구성을 사용할 수 있어야 합니다. 에이전트 및 베어 메탈 호스트를 삭제할 때 NMStateConfig 리소스를 삭제하지 마십시오.

1.5.3.7.5.1. 베어 메탈 호스트를 사용하여 관리형 클러스터 노드 제거

허브 클러스터에 베어 메탈 호스트가 있고 관리 클러스터에서 관리 클러스터 노드를 제거하려면 다음 단계를 완료합니다.

삭제하려는 노드의

BareMetalHost리소스에 다음 주석을 추가합니다.bmac.agent-install.openshift.io/remove-agent-and-node-on-delete: true다음 명령을 실행하여

BareMetalHost리소스를 삭제합니다. <bmh-name>을BareMetalHost의 이름으로 바꿉니다.oc delete bmh <bmh-name>

1.5.3.7.5.2. 베어 메탈 호스트 없이 관리형 클러스터 노드 제거

hub 클러스터에 베어 메탈 호스트가 없고 관리 클러스터에서 관리 클러스터 노드를 제거하려면 OpenShift Container Platform 설명서의 노드 삭제 지침을 따르십시오.

1.5.3.7.6. 추가 리소스

- 제로 터치 프로비저닝에 대한 자세한 내용은 OpenShift Container Platform 설명서 의 네트워크 맨 위에 있는 클러스터를 참조하십시오.

- 베어 메탈 호스트 사용에 필요한 포트에 대한 자세한 내용은 OpenShift Container Platform 설명서 의 대역 외 관리 IP 주소에 대한 포트 액세스를 참조하십시오.

- 루트 장치 팁에 대한 자세한 내용은 OpenShift Container Platform 설명서 의 BareMetalHost 사양 을 참조하십시오.

- 이미지 풀 시크릿 사용을참조하십시오.

- 온-프레미스 환경에 대한 인증 정보 생성을 참조하십시오.

- 컴퓨팅 머신 스케일링에 대한 자세한 내용은 OpenShift Container Platform 설명서에서 컴퓨팅 머신 세트 수동 스케일링을 참조하십시오.

- 통합 흐름에 대한 자세한 내용은 배포 후 보류 중 상태의 관리형 클러스터를 참조하십시오.

- BMC 형식 주소 지정에 대한 자세한 내용은 OpenShift Container Platform 설명서의 BMC 주소 지정을 참조하십시오.

1.5.3.8. 호스트 인벤토리 관리

콘솔을 사용하거나 명령줄 인터페이스를 사용하여 호스트 인벤토리를 관리하고 기존 호스트를 편집하고 Agent 리소스를 편집할 수 있습니다.

1.5.3.8.1. 콘솔을 사용하여 호스트 인벤토리 관리

Discovery ISO로 성공적으로 부팅한 각 호스트는 호스트 인벤토리에 행으로 표시됩니다. 콘솔을 사용하여 호스트를 편집하고 관리할 수 있습니다. 호스트를 수동으로 부팅하고 베어 메탈 Operator 자동화를 사용하지 않는 경우 콘솔에서 호스트를 승인해야 사용할 수 있습니다. OpenShift 노드로 설치할 준비가 된 호스트의 상태는 Available 입니다.

1.5.3.8.2. 명령줄 인터페이스를 사용하여 호스트 인벤토리 관리

에이전트 리소스는 각 호스트를 나타냅니다. 에이전트 리소스에서 다음 속성을 설정할 수 있습니다.

clusterDeploymentName이 속성을 클러스터에 노드로 설치하려는 경우 사용할

ClusterDeployment의 네임스페이스 및 이름으로 설정합니다.선택 사항:

role클러스터에서 호스트의 역할을 설정합니다. 가능한 값은

master,worker,auto-assign입니다. 기본값은auto-assign입니다.hostname호스트의 호스트 이름을 설정합니다. 호스트에 유효한 호스트 이름이 자동으로 할당되는 경우(예: DHCP 사용) 선택 사항입니다.

승인됨호스트를 OpenShift 노드로 설치할 수 있는지 여부를 나타냅니다. 이 속성은 기본값이

False인 부울입니다. 호스트를 수동으로 부팅하고 베어 메탈 Operator 자동화를 사용하지 않는 경우 호스트를 설치하기 전에 이 속성을True로 설정해야 합니다.installation_disk_id선택한 설치 디스크의 ID가 호스트의 인벤토리에 표시됩니다.

installerArgs호스트의 coreos-installer 인수에 대한 덮어쓰기가 포함된 JSON 형식의 문자열입니다. 이 속성을 사용하여 커널 인수를 수정할 수 있습니다. 다음 예제 구문을 참조하십시오.

["--append-karg", "ip=192.0.2.2::192.0.2.254:255.255.255.0:core0.example.com:enp1s0:none", "--save-partindex", "4"]ignitionConfigOverrides호스트의 ignition 구성에 대한 덮어쓰기가 포함된 JSON 형식의 문자열입니다. 이 속성을 사용하여 ignition을 사용하여 호스트에 파일을 추가할 수 있습니다. 다음 예제 구문을 참조하십시오.

{"ignition": "version": "3.1.0"}, "storage": {"files": [{"path": "/tmp/example", "contents": {"source": "data:text/plain;base64,aGVscGltdHJhcHBlZGluYXN3YWdnZXJzcGVj"}}]}}nodeLabels호스트를 설치한 후 노드에 적용되는 라벨 목록입니다.

에이전트 리소스의 상태에 는 다음과 같은 속성이 있습니다.

role클러스터에서 호스트의 역할을 설정합니다. 이전에

Agent리소스에서역할을설정하면 값이상태에표시됩니다.인벤토리호스트에서 실행 중인 에이전트가 검색하는 호스트 속성을 포함합니다.

진행 상황호스트 설치 진행 중입니다.

ntpSources호스트의 구성된 NTP(Network Time Protocol) 소스입니다.

conditionsTrue또는False값과 함께 다음 표준 Kubernetes 조건을 포함합니다.-

SpecSynced: 지정된 모든 속성이 성공적으로 적용되면

True입니다.false오류가 발생하면 false입니다. -

connected: 설치 서비스에 대한 에이전트 연결이 중단되지 않으면

True입니다. 에이전트가 잠시 후에 설치 서비스에 도달하지 않은 경우false입니다. -

RequirementsMet: 호스트가 설치를 시작할 준비가 되면

True입니다. -

validated: 모든 호스트 검증이 통과하면

True입니다. -

installed: 호스트가 OpenShift 노드로 설치된 경우

True입니다. -

Bound: 호스트가 클러스터에 바인딩된 경우

True입니다. -

cleanup:

Agentresouce를 삭제하라는 요청이 실패하면False입니다.

-

SpecSynced: 지정된 모든 속성이 성공적으로 적용되면

debugInfo설치 로그 및 이벤트를 다운로드하기 위한 URL이 포함되어 있습니다.

validationsInfo설치에 성공했는지 확인하기 위해 호스트가 검색된 후 에이전트가 실행되는 검증에 대한 정보가 포함되어 있습니다. 값이

False인 경우 문제를 해결합니다.installation_disk_id선택한 설치 디스크의 ID가 호스트의 인벤토리에 표시됩니다.

1.5.3.8.3. 추가 리소스

- 호스트 인벤토리 액세스를참조하십시오.

- coreos-installer 설치참조

1.5.4. 클러스터 생성

다중 클러스터 엔진 Operator를 사용하여 클라우드 공급자 간에 Red Hat OpenShift Container Platform 클러스터를 생성하는 방법을 알아봅니다.

다중 클러스터 엔진 Operator는 OpenShift Container Platform과 함께 제공되는 Hive Operator를 사용하여 온프레미스 클러스터 및 호스팅 컨트롤 플레인을 제외한 모든 공급자의 클러스터를 프로비저닝합니다. 온프레미스 클러스터를 프로비저닝할 때 다중 클러스터 엔진 Operator는 OpenShift Container Platform과 함께 제공되는 중앙 인프라 관리 및 지원 설치 관리자 기능을 사용합니다. 호스팅된 컨트롤 플레인의 호스트 클러스터는 HyperShift Operator를 사용하여 프로비저닝됩니다.

- 클러스터 생성 중 추가 매니페스트 구성

- Amazon Web Services에서 클러스터 생성

- Amazon Web Services GovCloud에서 클러스터 생성

- Microsoft Azure에 클러스터 생성

- Google Cloud Platform에서 클러스터 생성

- VMware vSphere에서 클러스터 생성

- Red Hat OpenStack Platform에서 클러스터 생성

- Red Hat Virtualization에서 클러스터 생성 (더 이상 사용되지 않음)

- 온-프레미스 환경에서 클러스터 생성

- AgentClusterInstall 프록시 구성

- 호스팅된 컨트롤 플레인

1.5.4.1. CLI를 사용하여 클러스터 생성

Kubernetes Operator용 멀티 클러스터 엔진은 내부 Hive 구성 요소를 사용하여 Red Hat OpenShift Container Platform 클러스터를 생성합니다. 클러스터 생성 방법을 알아보려면 다음 정보를 참조하십시오.

1.5.4.1.1. 사전 요구 사항

클러스터를 생성하기 전에 clusterImageSets 리포지토리를 복제하여 hub 클러스터에 적용해야 합니다. 다음 단계를 참조하십시오.

다음 명령을 실행하여 복제하지만

2.x를 2.5로 바꿉니다.git clone https://github.com/stolostron/acm-hive-openshift-releases.git cd acm-hive-openshift-releases git checkout origin/backplane-<2.x>다음 명령을 실행하여 hub 클러스터에 적용합니다.

find clusterImageSets/fast -type d -exec oc apply -f {} \; 2> /dev/null

클러스터를 생성할 때 Red Hat OpenShift Container Platform 릴리스 이미지를 선택합니다.

참고: Nutanix 플랫폼을 사용하는 경우 ClusterImageSet 리소스의 releaseImage 에 x86_64 아키텍처를 사용하고 표시되는 라벨 값을 'true' 로 설정해야 합니다. 다음 예제를 참조하십시오.

apiVersion: hive.openshift.io/v1

kind: ClusterImageSet

metadata:

labels:

channel: stable

visible: 'true'

name: img4.x.47-x86-64-appsub

spec:

releaseImage: quay.io/openshift-release-dev/ocp-release:4.x.47-x86_641.5.4.1.2. ClusterDeployment을 사용하여 클러스터 생성

ClusterDeployment 은 클러스터의 라이프사이클을 제어하는 데 사용되는 Hive 사용자 정의 리소스입니다.

Hive 사용 설명서에 따라 ClusterDeployment 사용자 정의 리소스를 생성하고 개별 클러스터를 생성합니다.

1.5.4.1.3. ClusterPool로 클러스터 생성

ClusterPool 은 여러 클러스터를 생성하는 데 사용되는 Hive 사용자 정의 리소스이기도 합니다.

Cluster Pools 문서에 따라 Hive ClusterPool API로 클러스터를 생성합니다.

1.5.4.2. 클러스터 생성 중 추가 매니페스트 구성

클러스터를 생성하는 설치 프로세스 중에 추가 Kubernetes 리소스 매니페스트를 구성할 수 있습니다. 이는 네트워킹 구성 또는 로드 밸런서 설정과 같은 시나리오에 대한 추가 매니페스트를 구성해야 하는 경우 도움이 될 수 있습니다.

클러스터를 생성하기 전에 추가 리소스 매니페스트가 포함된 ConfigMap 을 지정하는 ClusterDeployment 리소스에 대한 참조를 추가해야 합니다.

참고: ClusterDeployment 리소스 및 ConfigMap 은 동일한 네임스페이스에 있어야 합니다. 다음 예제에서는 콘텐츠 표시 방법을 보여줍니다.

리소스 매니페스트가 있는 ConfigMap

다른

ConfigMap리소스가 포함된 매니페스트가 포함된ConfigMap입니다. 리소스 매니페스트ConfigMap은data.<resource_name>\.yaml 패턴에 추가된 리소스구성으로 여러 키를 포함할 수 있습니다.kind: ConfigMap apiVersion: v1 metadata: name: <my-baremetal-cluster-install-manifests> namespace: <mynamespace> data: 99_metal3-config.yaml: | kind: ConfigMap apiVersion: v1 metadata: name: metal3-config namespace: openshift-machine-api data: http_port: "6180" provisioning_interface: "enp1s0" provisioning_ip: "172.00.0.3/24" dhcp_range: "172.00.0.10,172.00.0.100" deploy_kernel_url: "http://172.00.0.3:6180/images/ironic-python-agent.kernel" deploy_ramdisk_url: "http://172.00.0.3:6180/images/ironic-python-agent.initramfs" ironic_endpoint: "http://172.00.0.3:6385/v1/" ironic_inspector_endpoint: "http://172.00.0.3:5150/v1/" cache_url: "http://192.168.111.1/images" rhcos_image_url: "https://releases-art-rhcos.svc.ci.openshift.org/art/storage/releases/rhcos-4.3/43.81.201911192044.0/x86_64/rhcos-43.81.201911192044.0-openstack.x86_64.qcow2.gz"리소스 매니페스트

ConfigMap을 참조하는 ClusterDeployment리소스 매니페스트

ConfigMap은spec.provisioning.manifestsConfigMapRef에서 참조됩니다.apiVersion: hive.openshift.io/v1 kind: ClusterDeployment metadata: name: <my-baremetal-cluster> namespace: <mynamespace> annotations: hive.openshift.io/try-install-once: "true" spec: baseDomain: test.example.com clusterName: <my-baremetal-cluster> controlPlaneConfig: servingCertificates: {} platform: baremetal: libvirtSSHPrivateKeySecretRef: name: provisioning-host-ssh-private-key provisioning: installConfigSecretRef: name: <my-baremetal-cluster-install-config> sshPrivateKeySecretRef: name: <my-baremetal-hosts-ssh-private-key> manifestsConfigMapRef: name: <my-baremetal-cluster-install-manifests> imageSetRef: name: <my-clusterimageset> sshKnownHosts: - "10.1.8.90 ecdsa-sha2-nistp256 AAAAE2VjZHNhLXvVVVKUYVkuyvkuygkuyTCYTytfkufTYAAAAIbmlzdHAyNTYAAABBBKWjJRzeUVuZs4yxSy4eu45xiANFIIbwE3e1aPzGD58x/NX7Yf+S8eFKq4RrsfSaK2hVJyJjvVIhUsU9z2sBJP8=" pullSecretRef: name: <my-baremetal-cluster-pull-secret>

1.5.4.3. Amazon Web Services에서 클러스터 생성

다중 클러스터 엔진 Operator 콘솔을 사용하여 AWS(Amazon Web Services)에서 Red Hat OpenShift Container Platform 클러스터를 생성할 수 있습니다.

클러스터를 생성할 때 생성 프로세스는 OpenShift Container Platform 설치 프로그램을 Hive 리소스와 함께 사용합니다. 이 절차를 완료한 후 클러스터 생성에 대한 질문이 있는 경우 OpenShift Container Platform 설명서에서 AWS에 설치 프로세스를 참조하십시오.

1.5.4.3.1. 사전 요구 사항

AWS에서 클러스터를 생성하기 전에 다음 사전 요구 사항을 참조하십시오.

- 배포된 허브 클러스터가 있어야 합니다.

- AWS 인증 정보가 필요합니다. 자세한 내용은 Amazon Web Services의 인증 정보 생성을 참조하십시오.

- AWS에 구성된 도메인이 필요합니다. 도메인 구성 방법에 대한 지침은 AWS 계정 구성을 참조하십시오.

- 사용자 이름, 암호, 액세스 키 ID 및 시크릿 액세스 키가 포함된 AWS(Amazon Web Services) 로그인 인증 정보가 있어야 합니다. 보안 인증 정보 이해 및 가져오기를 참조하십시오.

OpenShift Container Platform 이미지 풀 시크릿이 있어야 합니다. 이미지 풀 시크릿 사용을 참조하십시오.

참고: 클라우드 공급자의 클라우드 공급자 액세스 키를 변경하는 경우 콘솔에서 클라우드 공급자에 대한 해당 인증 정보도 수동으로 업데이트해야 합니다. 이는 관리 클러스터가 호스팅되는 클라우드 공급자에서 인증 정보가 만료되고 관리 클러스터를 삭제하려고 할 때 필요합니다.

1.5.4.3.2. AWS 클러스터 생성

AWS 클러스터 생성에 대한 다음 중요한 정보를 참조하십시오.

-

정보를 검토하고 선택적으로 클러스터를 생성하기 전에 사용자 지정할 때 YAML: On 을 선택하여 패널의

install-config.yaml파일 콘텐츠를 볼 수 있습니다. 업데이트가 있는 경우 사용자 지정 설정으로 YAML 파일을 편집할 수 있습니다. - 클러스터를 생성할 때 컨트롤러는 클러스터 및 리소스에 대한 네임스페이스를 생성합니다. 해당 네임스페이스에 해당 클러스터 인스턴스의 리소스만 포함해야 합니다.

- 클러스터를 삭제하면 네임스페이스와 모든 리소스가 삭제됩니다.

-

기존 클러스터 세트에 클러스터를 추가하려면 클러스터에 추가하려면 클러스터에 대한 올바른 권한이 있어야 합니다. 클러스터를 생성할 때

cluster-admin권한이 없는 경우clusterset-admin권한이 있는 클러스터 세트를 선택해야 합니다. -

지정된 클러스터 세트에 대한 올바른 권한이 없는 경우 클러스터 생성에 실패합니다. 선택할 클러스터 설정 옵션이 없는 경우 클러스터 세트에

clusterset-admin권한을 제공하려면 클러스터 관리자에게 문의하십시오. -

모든 관리 클러스터는 관리 클러스터 세트와 연결되어 있어야 합니다.

ManagedClusterSet에 관리 클러스터를 할당하지 않으면기본관리 클러스터 세트에 자동으로 추가됩니다. - AWS 계정으로 구성한 선택한 인증 정보와 연결된 기본 DNS 도메인이 이미 있는 경우 해당 값이 필드에 채워집니다. 값을 덮어 쓰기하여 변경할 수 있습니다. 이 이름은 클러스터의 호스트 이름에 사용됩니다.

- 릴리스 이미지는 클러스터를 생성하는 데 사용되는 OpenShift Container Platform 이미지의 버전을 식별합니다. 사용 가능한 이미지 목록에서 이미지를 선택합니다. 사용하려는 이미지를 사용할 수 없는 경우 사용하려는 이미지의 URL을 입력할 수 있습니다.

노드 풀에는 컨트롤 플레인 풀과 작업자 풀이 포함됩니다. 컨트롤 플레인 노드는 클러스터 활동 관리를 공유합니다. 정보에는 다음 필드가 포함됩니다.

- region: 노드 풀을 원하는 리전을 지정합니다.

- CPU 아키텍처: 관리 클러스터의 아키텍처 유형이 허브 클러스터의 아키텍처와 동일하지 않으면 풀에 있는 시스템의 명령 집합 아키텍처 값을 입력합니다. 유효한 값은 amd64,ppc64le,s390x 및 arm64 입니다.

- zones: 컨트롤 플레인 풀을 실행할 위치를 지정합니다. 더 분산된 컨트롤 플레인 노드 그룹에 대해 리전 내에서 여러 영역을 선택할 수 있습니다. 더 가까운 영역은 더 빠른 성능을 제공할 수 있지만 더 멀리 있는 영역이 더 분산될 수 있습니다.

- 인스턴스 유형: 컨트롤 플레인 노드의 인스턴스 유형을 지정합니다. 인스턴스 유형 및 크기를 생성한 후 변경할 수 있습니다.

- 루트 스토리지: 클러스터에 할당할 루트 스토리지 크기를 지정합니다.

작업자 풀에 0개 이상의 작업자 노드를 생성하여 클러스터의 컨테이너 워크로드를 실행할 수 있습니다. 이는 단일 작업자 풀에 있거나 여러 작업자 풀에 분산될 수 있습니다. 제로 작업자 노드가 지정되면 컨트롤 플레인 노드도 작업자 노드로 작동합니다. 선택적 정보에는 다음 필드가 포함됩니다.

- zones: 작업자 풀을 실행할 위치를 지정합니다. 더 분산된 노드 그룹에 대해 리전 내에서 여러 영역을 선택할 수 있습니다. 더 가까운 영역은 더 빠른 성능을 제공할 수 있지만 더 멀리 있는 영역이 더 분산될 수 있습니다.

- 인스턴스 유형: 작업자 풀의 인스턴스 유형을 지정합니다. 인스턴스 유형 및 크기를 생성한 후 변경할 수 있습니다.

- 노드 수: 작업자 풀의 노드 수를 지정합니다. 이 설정은 작업자 풀을 정의할 때 필요합니다.

- 루트 스토리지: 작업자 풀에 할당된 루트 스토리지의 양을 지정합니다. 이 설정은 작업자 풀을 정의할 때 필요합니다.

- 클러스터에 네트워킹 세부 정보가 필요하며 IPv6를 사용하려면 여러 네트워크가 필요합니다. 네트워크 추가를 클릭하여 추가 네트워크를 추가할 수 있습니다.

인증 정보에 제공된 프록시 정보는 프록시 필드에 자동으로 추가됩니다. 정보를 그대로 사용하거나, 덮어쓰거나 프록시를 활성화하려면 정보를 추가할 수 있습니다. 다음 목록에는 프록시를 생성하는 데 필요한 정보가 포함되어 있습니다.

-

HTTP 프록시:

HTTP트래픽의 프록시로 사용해야 하는 URL을 지정합니다. -

HTTPS 프록시:

HTTPS트래픽에 사용해야 하는 보안 프록시 URL을 지정합니다. 값을 제공하지 않으면 HTTP 및HTTPS모두에HTTP프록시 URL -

프록시 사이트 없음: 프록시를 바이패스해야 하는 쉼표로 구분된 사이트 목록입니다. 마침표로 도메인 이름을 시작합니다

.를 해당 도메인에 있는 모든 하위 도메인을 포함합니다. 모든 대상에 대해 프록시를 바이패스하려면 별표*를 추가합니다. - 추가 신뢰 번들: HTTPS 연결을 프록시하는 데 필요한 하나 이상의 추가 CA 인증서입니다.

-

HTTP 프록시:

1.5.4.3.3. 콘솔을 사용하여 클러스터 생성

새 클러스터를 생성하려면 다음 절차를 참조하십시오. 대신 가져올 기존 클러스터가 있는 경우 클러스터 가져오기 를 참조하십시오.

참고: 클러스터를 가져오기 위해 클러스터 세부 정보가 제공된 oc 명령을 실행할 필요가 없습니다. 클러스터를 생성할 때 다중 클러스터 엔진 Operator 관리 아래에 자동으로 구성됩니다.

- Infrastructure > Clusters 로 이동합니다.

- 클러스터 페이지에서 다음을 수행합니다. 클러스터 > 클러스터 생성 을 클릭하고 콘솔의 단계를 완료합니다.

- 선택 사항: 콘솔에서 정보를 입력할 때 콘텐츠 업데이트를 보려면 YAML 을 선택합니다.

인증 정보를 생성해야 하는 경우 자세한 내용은 Amazon Web Services에 대한 인증 정보 생성 을 참조하십시오.

클러스터 이름은 클러스터의 호스트 이름에 사용됩니다.

Kubernetes용 Red Hat Advanced Cluster Management를 사용하고 관리 클러스터 klusterlet을 특정 노드에서 실행하도록 구성하려면 선택 사항: 필요한 단계를 위해 특정 노드에서 실행되도록 klusterlet 구성 을 참조하십시오.

1.5.4.3.4. 추가 리소스

- AWS 개인 구성 정보는 AWS GovCloud 클러스터를 생성할 때 사용됩니다. 해당 환경에서 클러스터 생성에 대한 정보는 Amazon Web Services GovCloud 에서 클러스터 생성을 참조하십시오.

- 자세한 내용은 AWS 계정 구성을 참조하십시오.

- 릴리스 이미지에 대한 자세한 내용은 릴리스 이미지 릴리스를 참조하십시오.

- AWS General purpose instances 와 같은 클라우드 공급자 사이트를 방문하여 지원되는 즉시 유형에 대한 자세한 내용을 확인하십시오.

1.5.4.4. Amazon Web Services GovCloud에서 클러스터 생성

콘솔을 사용하여 AWS(Amazon Web Services) 또는 AWS GovCloud에 Red Hat OpenShift Container Platform 클러스터를 생성할 수 있습니다. 다음 절차에서는 AWS GovCloud에 클러스터를 생성하는 방법을 설명합니다. AWS 에서 클러스터를 생성하는 방법은 Amazon Web Services 에서 클러스터 생성을 참조하십시오.

AWS GovCloud는 정부 문서를 클라우드에 저장하는 데 필요한 추가 요구 사항을 충족하는 클라우드 서비스를 제공합니다. AWS GovCloud에서 클러스터를 생성할 때 환경을 준비하려면 추가 단계를 완료해야 합니다.

클러스터를 생성할 때 생성 프로세스는 OpenShift Container Platform 설치 프로그램을 Hive 리소스와 함께 사용합니다. 이 절차를 완료한 후 클러스터 생성에 대한 질문이 있는 경우 OpenShift Container Platform 설명서의 정부 리전에 AWS의 클러스터 설치를 참조하십시오. 다음 섹션에서는 AWS GovCloud에 클러스터를 생성하는 단계를 제공합니다.

1.5.4.4.1. 사전 요구 사항

AWS GovCloud 클러스터를 생성하기 전에 다음 사전 요구 사항이 있어야합니다.

- 사용자 이름, 암호, 액세스 키 ID 및 시크릿 액세스 키가 포함된 AWS 로그인 인증 정보가 있어야 합니다. 보안 인증 정보 이해 및 가져오기를 참조하십시오.

- AWS 인증 정보가 필요합니다. 자세한 내용은 Amazon Web Services의 인증 정보 생성을 참조하십시오.

- AWS에 구성된 도메인이 필요합니다. 도메인 구성 방법에 대한 지침은 AWS 계정 구성을 참조하십시오.

- OpenShift Container Platform 이미지 풀 시크릿이 있어야 합니다. 이미지 풀 시크릿 사용을 참조하십시오.

- 허브 클러스터용 기존 Red Hat OpenShift Container Platform 클러스터가 있는 Amazon VPC(Virtual Private Cloud)가 있어야 합니다. 이 VPC는 관리 클러스터 리소스 또는 관리형 클러스터 서비스 엔드 포인트에 사용되는 VPC와 달라야 합니다.

- 관리 클러스터 리소스가 배포되는 VPC가 필요합니다. 허브 클러스터 또는 관리 클러스터 서비스 엔드 포인트에 사용되는 VPC와 같을 수 없습니다.

- 관리 클러스터 서비스 엔드 포인트를 제공하는 VPC가 하나 이상 필요합니다. Hub 클러스터 또는 관리 클러스터 리소스에 사용되는 VPC와 같을 수 없습니다.

- CIDR(Classless Inter-Domain Routing)으로 지정된 VPC의 IP 주소가 겹치지 않는지 확인합니다.

-

Hive 네임스페이스 내에서 인증 정보를 참조하는

HiveConfig사용자 정의 리소스가 필요합니다. 이 사용자 정의 리소스는 관리형 클러스터 서비스 엔드포인트에 대해 생성한 VPC에 리소스를 생성할 수 있어야 합니다.

참고: 클라우드 공급자의 클라우드 공급자 액세스 키를 변경하는 경우 다중 클러스터 엔진 Operator 콘솔에서 클라우드 공급자에 대한 해당 인증 정보도 수동으로 업데이트해야 합니다. 이는 관리 클러스터가 호스팅되는 클라우드 공급자에서 인증 정보가 만료되고 관리 클러스터를 삭제하려고 할 때 필요합니다.

1.5.4.4.2. AWS GovCloud에 배포하도록 Hive 구성

AWS GovCloud에서 클러스터를 생성하는 것은 표준 AWS에서 클러스터를 생성하는 것과 거의 동일하지만 AWS GovCloud에서 클러스터에 대한 AWS PrivateLink를 준비하기 위해 몇 가지 추가 단계를 완료해야 합니다.

1.5.4.4.2.1. 리소스 및 엔드포인트에 대한 VPC 생성

사전 요구 사항에 나열된 대로 허브 클러스터가 포함된 VPC 외에도 두 개의 VPC가 필요합니다. VPC를 생성하기 위한 특정 단계는 Amazon Web Services 설명서에서 VPC 생성을 참조하십시오.

- 프라이빗 서브넷을 사용하여 관리형 클러스터의 VPC를 생성합니다.

- 프라이빗 서브넷을 사용하여 관리형 클러스터 서비스 엔드 포인트에 대해 VPC를 하나 이상 생성합니다. 리전의 각 VPC에는 255개의 VPC 끝점이 있으므로 해당 리전에서 255개 이상의 클러스터를 지원하려면 여러 VPC가 필요합니다.

각 VPC에 대해 해당 리전의 지원되는 모든 가용성 영역에 서브넷을 생성합니다. 각 서브넷에는 컨트롤러 요구 사항으로 인해 최소 255개의 사용 가능한 IP 주소가 있어야 합니다.

다음 예제에서는

us-gov-east-1리전에 6개의 가용성 영역이 있는 VPC의 서브넷을 구조화하는 방법을 보여줍니다.vpc-1 (us-gov-east-1) : 10.0.0.0/20 subnet-11 (us-gov-east-1a): 10.0.0.0/23 subnet-12 (us-gov-east-1b): 10.0.2.0/23 subnet-13 (us-gov-east-1c): 10.0.4.0/23 subnet-12 (us-gov-east-1d): 10.0.8.0/23 subnet-12 (us-gov-east-1e): 10.0.10.0/23 subnet-12 (us-gov-east-1f): 10.0.12.0/2vpc-2 (us-gov-east-1) : 10.0.16.0/20 subnet-21 (us-gov-east-1a): 10.0.16.0/23 subnet-22 (us-gov-east-1b): 10.0.18.0/23 subnet-23 (us-gov-east-1c): 10.0.20.0/23 subnet-24 (us-gov-east-1d): 10.0.22.0/23 subnet-25 (us-gov-east-1e): 10.0.24.0/23 subnet-26 (us-gov-east-1f): 10.0.28.0/23- 모든 허브 환경(hub 클러스터 VPC)이 피어링, 전송 게이트웨이를 사용하는 VPC 끝점에 대해 생성한 VPC에 대한 네트워크 연결이 있고 모든 DNS 설정이 활성화되어 있는지 확인합니다.

- AWS GovCloud 연결에 필요한 AWS PrivateLink의 DNS 설정을 확인하는 데 필요한 VPC 목록을 수집합니다. 여기에는 최소한 구성 중인 다중 클러스터 엔진 Operator 인스턴스의 VPC가 포함되며, 다양한 Hive 컨트롤러가 존재하는 모든 VPC 목록을 포함할 수 있습니다.

1.5.4.4.2.2. VPC 끝점의 보안 그룹 구성

AWS의 각 VPC 끝점에는 끝점에 대한 액세스를 제어하기 위해 연결된 보안 그룹이 있습니다. Hive는 VPC 끝점을 생성할 때 보안 그룹을 지정하지 않습니다. VPC의 기본 보안 그룹은 VPC 끝점에 연결되어 있습니다. VPC의 기본 보안 그룹에는 Hive 설치 프로그램 Pod에서 VPC 엔드 포인트가 생성되는 트래픽을 허용하기 위한 규칙이 있어야 합니다. 자세한 내용은 AWS 문서의 엔드 포인트 정책을 사용하여 VPC 끝점에 대한 액세스 제어를 참조하십시오.

예를 들어 Hive가 hive-vpc(10.1.0.0/16) 에서 실행되는 경우 VPC의 기본 보안 그룹에는 10.1.0.0/16 에서 수신할 수 있는 VPC 끝점이 생성되는 규칙이 있어야 합니다.

1.5.4.4.2.3. AWS PrivateLink에 대한 권한 설정

AWS PrivateLink를 구성하려면 여러 인증 정보가 필요합니다. 이러한 인증 정보에 필요한 권한은 인증 정보 유형에 따라 다릅니다.

ClusterDeployment의 인증 정보에는 다음 권한이 필요합니다.

ec2:CreateVpcEndpointServiceConfiguration ec2:DescribeVpcEndpointServiceConfigurations ec2:ModifyVpcEndpointServiceConfiguration ec2:DescribeVpcEndpointServicePermissions ec2:ModifyVpcEndpointServicePermissions ec2:DeleteVpcEndpointServiceConfigurations끝점 VPC 계정

.spec.awsPrivateLink.credentialsSecretRef에 대한 HiveConfig의 인증 정보에는 다음 권한이 필요합니다.ec2:DescribeVpcEndpointServices ec2:DescribeVpcEndpoints ec2:CreateVpcEndpoint ec2:CreateTags ec2:DescribeNetworkInterfaces ec2:DescribeVPCs ec2:DeleteVpcEndpoints route53:CreateHostedZone route53:GetHostedZone route53:ListHostedZonesByVPC route53:AssociateVPCWithHostedZone route53:DisassociateVPCFromHostedZone route53:CreateVPCAssociationAuthorization route53:DeleteVPCAssociationAuthorization route53:ListResourceRecordSets route53:ChangeResourceRecordSets route53:DeleteHostedZoneVPC를 프라이빗 호스팅 영역(

.spec.awsPrivateLink.associatedVPCs[$idx].credentialsSecretRef)에 연결하기 위해HiveConfig사용자 정의 리소스에 지정된 인증 정보입니다. VPC가 있는 계정에는 다음 권한이 필요합니다.route53:AssociateVPCWithHostedZone route53:DisassociateVPCFromHostedZone ec2:DescribeVPCs

hub 클러스터의 Hive 네임스페이스에 인증 정보 시크릿이 있는지 확인합니다.

HiveConfig 사용자 정의 리소스는 제공된 특정 VPC에서 리소스를 생성할 수 있는 권한이 있는 Hive 네임스페이스 내의 인증 정보를 참조해야 합니다. AWS GovCloud에서 AWS 클러스터를 프로비저닝하기 위해 사용 중인 인증 정보가 Hive 네임스페이스에 이미 있는 경우 다른 인증서를 생성할 필요가 없습니다. AWS GovCloud에서 AWS 클러스터를 프로비저닝하기 위해 사용 중인 인증 정보가 Hive 네임스페이스에 없는 경우 현재 인증 정보를 교체하거나 Hive 네임스페이스에서 추가 인증 정보를 생성할 수 있습니다.

HiveConfig 사용자 정의 리소스에는 다음 콘텐츠를 포함해야 합니다.

- 지정된 VPC의 리소스를 프로비저닝하는 데 필요한 권한이 있는 AWS GovCloud 인증 정보입니다.

OpenShift Container Platform 클러스터 설치용 VPC 주소와 관리형 클러스터의 서비스 끝점입니다.

모범 사례: OpenShift Container Platform 클러스터 설치 및 서비스 끝점에 다른 VPC를 사용합니다.

다음 예제에서는 인증 정보 콘텐츠를 보여줍니다.

spec:

awsPrivateLink:

## The list of inventory of VPCs that can be used to create VPC

## endpoints by the controller.

endpointVPCInventory:

- region: us-east-1

vpcID: vpc-1

subnets:

- availabilityZone: us-east-1a

subnetID: subnet-11

- availabilityZone: us-east-1b

subnetID: subnet-12

- availabilityZone: us-east-1c

subnetID: subnet-13

- availabilityZone: us-east-1d

subnetID: subnet-14

- availabilityZone: us-east-1e

subnetID: subnet-15

- availabilityZone: us-east-1f

subnetID: subnet-16

- region: us-east-1

vpcID: vpc-2

subnets:

- availabilityZone: us-east-1a

subnetID: subnet-21

- availabilityZone: us-east-1b

subnetID: subnet-22

- availabilityZone: us-east-1c

subnetID: subnet-23

- availabilityZone: us-east-1d

subnetID: subnet-24

- availabilityZone: us-east-1e

subnetID: subnet-25

- availabilityZone: us-east-1f

subnetID: subnet-26

## The credentialsSecretRef points to a secret with permissions to create.

## The resources in the account where the inventory of VPCs exist.

credentialsSecretRef:

name: <hub-account-credentials-secret-name>

## A list of VPC where various mce clusters exists.

associatedVPCs:

- region: region-mce1

vpcID: vpc-mce1

credentialsSecretRef:

name: <credentials-that-have-access-to-account-where-MCE1-VPC-exists>

- region: region-mce2

vpcID: vpc-mce2

credentialsSecretRef:

name: <credentials-that-have-access-to-account-where-MCE2-VPC-exists>

AWS PrivateLink가 endpointVPC인벤토리 목록에서 지원되는 모든 리전의 VPC 를 포함할 수 있습니다. 컨트롤러는 ClusterDeployment의 요구 사항을 충족하는 VPC를 선택합니다.

자세한 내용은 Hive 설명서를 참조하십시오.

1.5.4.4.3. 콘솔을 사용하여 클러스터 생성

콘솔에서 클러스터를 생성하려면 Infrastructure > Clusters > Create cluster > Standalone 로 이동하여 콘솔의 단계를 완료합니다.

참고: 이 절차는 클러스터를 생성하기 위한 것입니다. 가져올 기존 클러스터가 있는 경우 해당 단계에 대한 클러스터 가져오기 를 참조하십시오.

선택한 인증 정보는 AWS GovCloud 클러스터를 생성하는 경우 AWS GovCloud 리전의 리소스에 액세스할 수 있어야 합니다. 클러스터를 배포하는 데 필요한 권한이 있는 경우 Hive 네임스페이스에 이미 있는 AWS GovCloud 시크릿을 사용할 수 있습니다. 기존 인증 정보가 콘솔에 표시됩니다. 인증 정보를 생성해야 하는 경우 자세한 내용은 Amazon Web Services에 대한 인증 정보 생성 을 참조하십시오.

클러스터 이름은 클러스터의 호스트 이름에 사용됩니다.

중요: 클러스터를 생성할 때 컨트롤러는 클러스터 및 해당 리소스에 대한 네임스페이스를 생성합니다. 해당 네임스페이스에 해당 클러스터 인스턴스의 리소스만 포함해야 합니다. 클러스터를 삭제하면 네임스페이스와 모든 리소스가 삭제됩니다.

팁: 콘솔에서 정보를 입력할 때 콘텐츠 업데이트를 보려면 YAML 을 선택합니다.

기존 클러스터 세트에 클러스터를 추가하려면 클러스터에 추가하려면 클러스터에 대한 올바른 권한이 있어야 합니다. 클러스터를 생성할 때 cluster-admin 권한이 없는 경우 clusterset-admin 권한이 있는 클러스터 세트를 선택해야 합니다. 지정된 클러스터 세트에 대한 올바른 권한이 없는 경우 클러스터 생성에 실패합니다. 선택할 클러스터 설정 옵션이 없는 경우 클러스터 세트에 clusterset-admin 권한을 제공하려면 클러스터 관리자에게 문의하십시오.

모든 관리 클러스터는 관리 클러스터 세트와 연결되어 있어야 합니다. ManagedClusterSet 에 관리 클러스터를 할당하지 않으면 기본 관리 클러스터 세트에 자동으로 추가됩니다.

AWS 또는 AWS GovCloud 계정으로 구성한 선택한 인증 정보와 연결된 기본 DNS 도메인이 이미 있는 경우 해당 값이 필드에 채워집니다. 값을 덮어 쓰기하여 변경할 수 있습니다. 이 이름은 클러스터의 호스트 이름에 사용됩니다. 자세한 내용은 AWS 계정 구성을 참조하십시오.

릴리스 이미지는 클러스터를 생성하는 데 사용되는 OpenShift Container Platform 이미지의 버전을 식별합니다. 사용하려는 버전을 사용할 수 있는 경우 이미지 목록에서 이미지를 선택할 수 있습니다. 사용하려는 이미지가 표준 이미지가 아닌 경우 사용하려는 이미지의 URL을 입력할 수 있습니다. 릴리스 이미지에 대한 자세한 내용은 릴리스 이미지 릴리스를 참조하십시오.

노드 풀에는 컨트롤 플레인 풀과 작업자 풀이 포함됩니다. 컨트롤 플레인 노드는 클러스터 활동 관리를 공유합니다. 정보에는 다음 필드가 포함됩니다.

-

region: 클러스터 리소스를 생성하는 리전입니다. AWS GovCloud 공급자에 클러스터를 생성하는 경우 노드 풀의 AWS GovCloud 리전을 포함해야 합니다. 예를 들면

us-gov-west-1입니다. - CPU 아키텍처: 관리 클러스터의 아키텍처 유형이 허브 클러스터의 아키텍처와 동일하지 않으면 풀에 있는 시스템의 명령 집합 아키텍처 값을 입력합니다. 유효한 값은 amd64,ppc64le,s390x 및 arm64 입니다.

- zones: 컨트롤 플레인 풀을 실행할 위치를 지정합니다. 더 분산된 컨트롤 플레인 노드 그룹에 대해 리전 내에서 여러 영역을 선택할 수 있습니다. 더 가까운 영역은 더 빠른 성능을 제공할 수 있지만 더 멀리 있는 영역이 더 분산될 수 있습니다.

- 인스턴스 유형: 이전에 지정한 CPU 아키텍처와 동일해야 하는 컨트롤 플레인 노드의 인스턴스 유형을 지정합니다. 인스턴스 유형 및 크기를 생성한 후 변경할 수 있습니다.

- 루트 스토리지: 클러스터에 할당할 루트 스토리지 크기를 지정합니다.

작업자 풀에 0개 이상의 작업자 노드를 생성하여 클러스터의 컨테이너 워크로드를 실행할 수 있습니다. 단일 작업자 풀에 있거나 여러 작업자 풀에 배포할 수 있습니다. 제로 작업자 노드가 지정되면 컨트롤 플레인 노드도 작업자 노드로 작동합니다. 선택적 정보에는 다음 필드가 포함됩니다.

- 풀 이름: 풀에 고유한 이름을 제공합니다.

- zones: 작업자 풀을 실행할 위치를 지정합니다. 더 분산된 노드 그룹에 대해 리전 내에서 여러 영역을 선택할 수 있습니다. 더 가까운 영역은 더 빠른 성능을 제공할 수 있지만 더 멀리 있는 영역이 더 분산될 수 있습니다.

- 인스턴스 유형: 작업자 풀의 인스턴스 유형을 지정합니다. 인스턴스 유형 및 크기를 생성한 후 변경할 수 있습니다.

- 노드 수: 작업자 풀의 노드 수를 지정합니다. 이 설정은 작업자 풀을 정의할 때 필요합니다.

- 루트 스토리지: 작업자 풀에 할당된 루트 스토리지의 양을 지정합니다. 이 설정은 작업자 풀을 정의할 때 필요합니다.

클러스터에 네트워킹 세부 정보가 필요하며 IPv6를 사용하려면 여러 네트워크가 필요합니다. AWS GovCloud 클러스터의 경우 Machine CIDR 필드에 Hive VPC의 주소 블록 값을 입력합니다. 네트워크 추가를 클릭하여 추가 네트워크를 추가할 수 있습니다.

인증 정보에 제공된 프록시 정보는 프록시 필드에 자동으로 추가됩니다. 정보를 그대로 사용하거나, 덮어쓰거나 프록시를 활성화하려면 정보를 추가할 수 있습니다. 다음 목록에는 프록시를 생성하는 데 필요한 정보가 포함되어 있습니다.

-

HTTP 프록시 URL:

HTTP트래픽의 프록시로 사용해야 하는 URL을 지정합니다. -

HTTPS 프록시 URL:

HTTPS트래픽에 사용해야 하는 보안 프록시 URL을 지정합니다. 값을 제공하지 않으면 HTTP 및HTTPS모두에HTTP프록시 URL -

프록시 도메인 없음: 프록시를 바이패스해야 하는 쉼표로 구분된 도메인 목록입니다. 마침표로 도메인 이름을 시작합니다

.를 해당 도메인에 있는 모든 하위 도메인을 포함합니다. 모든 대상에 대해 프록시를 바이패스하려면 별표*를 추가합니다. - 추가 신뢰 번들: HTTPS 연결을 프록시하는 데 필요한 하나 이상의 추가 CA 인증서입니다.

AWS GovCloud 클러스터를 생성하거나 프라이빗 환경을 사용하는 경우 AMI ID 및 서브넷 값을 사용하여 AWS 개인 구성 페이지의 필드를 완료합니다. ClusterDeployment.yaml 파일에서 spec:platform:aws:privateLink:enabled 값이 true 로 설정되어 있는지 확인합니다. 이 값은 개인 구성 사용을 선택할 때 자동으로 설정됩니다.

정보를 검토하고 선택적으로 클러스터를 생성하기 전에 사용자 지정할 때 YAML: On 을 선택하여 패널의 install-config.yaml 파일 콘텐츠를 볼 수 있습니다. 업데이트가 있는 경우 사용자 지정 설정으로 YAML 파일을 편집할 수 있습니다.

참고: 클러스터를 가져오기 위해 클러스터 세부 정보가 제공된 oc 명령을 실행할 필요가 없습니다. 클러스터를 생성할 때 Kubernetes 운영자를 위한 다중 클러스터 엔진 관리 아래에 자동으로 구성됩니다.

Kubernetes용 Red Hat Advanced Cluster Management를 사용하고 관리 클러스터 klusterlet을 특정 노드에서 실행하도록 구성하려면 선택 사항: 필요한 단계를 위해 특정 노드에서 실행되도록 klusterlet 구성 을 참조하십시오.

클러스터에 액세스하는 방법에 대한 지침은 클러스터 액세스를 계속합니다.

1.5.4.5. Microsoft Azure에 클러스터 생성

다중 클러스터 엔진 Operator 콘솔을 사용하여 Microsoft Azure 또는 Microsoft Azure Government에 Red Hat OpenShift Container Platform 클러스터를 배포할 수 있습니다.

클러스터를 생성할 때 생성 프로세스는 OpenShift Container Platform 설치 프로그램을 Hive 리소스와 함께 사용합니다. 이 절차를 완료한 후 클러스터 생성에 대한 질문이 있는 경우 OpenShift Container Platform 설명서의 Azure에 프로세스에 대한 자세한 내용은 설치를 참조하십시오.

1.5.4.5.1. 사전 요구 사항

Azure에서 클러스터를 생성하기 전에 다음 사전 요구 사항을 참조하십시오.

- 배포된 허브 클러스터가 있어야 합니다.

- Azure 인증 정보가 필요합니다. 자세한 내용은 Microsoft Azure에 대한 인증 정보 생성 을 참조하십시오.

- Azure 또는 Azure Government에 구성된 도메인이 필요합니다. 도메인 구성 방법에 대한 지침은 Azure 클라우드 서비스의 사용자 정의 도메인 이름 구성을 참조하십시오.

- 사용자 이름과 암호를 포함하는 Azure 로그인 인증 정보가 필요합니다. Microsoft Azure Portal 을 참조하십시오.

-

clientId,clientSecret,tenantId를 포함하는 Azure 서비스 주체가 필요합니다. azure.microsoft.com 을 참조하십시오. - OpenShift Container Platform 이미지 풀 시크릿이 필요합니다. 이미지 풀 시크릿 사용을 참조하십시오.

참고: 클라우드 공급자의 클라우드 공급자 액세스 키를 변경하는 경우 다중 클러스터 엔진 Operator 콘솔에서 클라우드 공급자에 대한 해당 인증 정보도 수동으로 업데이트해야 합니다. 이는 관리 클러스터가 호스팅되는 클라우드 공급자에서 인증 정보가 만료되고 관리 클러스터를 삭제하려고 할 때 필요합니다.

1.5.4.5.2. 콘솔을 사용하여 클러스터 생성

다중 클러스터 엔진 Operator 콘솔에서 클러스터를 생성하려면 Infrastructure > Clusters 로 이동합니다. 클러스터 페이지에서 클러스터 생성 을 클릭하고 콘솔의 단계를 완료합니다.

참고: 이 절차는 클러스터를 생성하기 위한 것입니다. 가져올 기존 클러스터가 있는 경우 해당 단계에 대한 클러스터 가져오기 를 참조하십시오.

인증 정보를 생성해야 하는 경우 자세한 내용은 Microsoft Azure에 대한 인증 정보 생성 을 참조하십시오.

클러스터 이름은 클러스터의 호스트 이름에 사용됩니다.

중요: 클러스터를 생성할 때 컨트롤러는 클러스터 및 해당 리소스에 대한 네임스페이스를 생성합니다. 해당 네임스페이스에 해당 클러스터 인스턴스의 리소스만 포함해야 합니다. 클러스터를 삭제하면 네임스페이스와 모든 리소스가 삭제됩니다.

팁: 콘솔에서 정보를 입력할 때 콘텐츠 업데이트를 보려면 YAML 을 선택합니다.

기존 클러스터 세트에 클러스터를 추가하려면 클러스터에 추가하려면 클러스터에 대한 올바른 권한이 있어야 합니다. 클러스터를 생성할 때 cluster-admin 권한이 없는 경우 clusterset-admin 권한이 있는 클러스터 세트를 선택해야 합니다. 지정된 클러스터 세트에 대한 올바른 권한이 없는 경우 클러스터 생성에 실패합니다. 선택할 클러스터 설정 옵션이 없는 경우 클러스터 세트에 clusterset-admin 권한을 제공하려면 클러스터 관리자에게 문의하십시오.

모든 관리 클러스터는 관리 클러스터 세트와 연결되어 있어야 합니다. ManagedClusterSet 에 관리 클러스터를 할당하지 않으면 기본 관리 클러스터 세트에 자동으로 추가됩니다.

Azure 계정에 대해 구성한 선택한 인증 정보와 연결된 기본 DNS 도메인이 이미 있는 경우 해당 값이 해당 필드에 채워집니다. 값을 덮어 쓰기하여 변경할 수 있습니다. 자세한 내용은 Azure 클라우드 서비스의 사용자 정의 도메인 이름 구성 을 참조하십시오. 이 이름은 클러스터의 호스트 이름에 사용됩니다.

릴리스 이미지는 클러스터를 생성하는 데 사용되는 OpenShift Container Platform 이미지의 버전을 식별합니다. 사용하려는 버전을 사용할 수 있는 경우 이미지 목록에서 이미지를 선택할 수 있습니다. 사용하려는 이미지가 표준 이미지가 아닌 경우 사용하려는 이미지의 URL을 입력할 수 있습니다. 릴리스 이미지에 대한 자세한 내용은 릴리스 이미지 릴리스를 참조하십시오.

노드 풀에는 컨트롤 플레인 풀과 작업자 풀이 포함됩니다. 컨트롤 플레인 노드는 클러스터 활동 관리를 공유합니다. 정보에는 다음과 같은 선택적 필드가 포함됩니다.

- region: 노드 풀을 실행할 리전을 지정합니다. 더 분산된 컨트롤 플레인 노드 그룹에 대해 리전 내에서 여러 영역을 선택할 수 있습니다. 더 가까운 영역은 더 빠른 성능을 제공할 수 있지만 더 멀리 있는 영역이 더 분산될 수 있습니다.

- CPU 아키텍처: 관리 클러스터의 아키텍처 유형이 허브 클러스터의 아키텍처와 동일하지 않으면 풀에 있는 시스템의 명령 집합 아키텍처 값을 입력합니다. 유효한 값은 amd64,ppc64le,s390x 및 arm64 입니다.

클러스터를 생성한 후 컨트롤 플레인 풀의 인스턴스 유형 및 크기 및 루트 스토리지 할당(필수)을 변경할 수 있습니다.

작업자 풀에서 하나 이상의 작업자 노드를 생성하여 클러스터의 컨테이너 워크로드를 실행할 수 있습니다. 단일 작업자 풀에 있거나 여러 작업자 풀에 배포할 수 있습니다. 제로 작업자 노드가 지정되면 컨트롤 플레인 노드도 작업자 노드로 작동합니다. 정보에는 다음 필드가 포함됩니다.

- zones: 작업자 풀을 실행할 위치를 지정합니다. 더 분산된 노드 그룹에 대해 리전 내에서 여러 영역을 선택할 수 있습니다. 더 가까운 영역은 더 빠른 성능을 제공할 수 있지만 더 멀리 있는 영역이 더 분산될 수 있습니다.

- 인스턴스 유형: 인스턴스 유형을 만든 후 인스턴스의 유형과 크기를 변경할 수 있습니다.

네트워크 추가를 클릭하여 추가 네트워크를 추가할 수 있습니다. IPv6 주소를 사용하는 경우 두 개 이상의 네트워크가 있어야 합니다.

인증 정보에 제공된 프록시 정보는 프록시 필드에 자동으로 추가됩니다. 정보를 그대로 사용하거나, 덮어쓰거나 프록시를 활성화하려면 정보를 추가할 수 있습니다. 다음 목록에는 프록시를 생성하는 데 필요한 정보가 포함되어 있습니다.

-

HTTP 프록시:

HTTP트래픽의 프록시로 사용해야 하는 URL입니다. -

HTTPS 프록시:

HTTPS트래픽에 사용해야 하는 보안 프록시 URL입니다. 값을 제공하지 않으면 HTTP 및HTTPS모두에HTTP프록시 URL -

프록시 없음: 프록시를 바이패스해야 하는 쉼표로 구분된 도메인 목록입니다. 마침표로 도메인 이름을 시작합니다

.를 해당 도메인에 있는 모든 하위 도메인을 포함합니다. 모든 대상에 대해 프록시를 바이패스하려면 별표*를 추가합니다. - 추가 신뢰 번들: HTTPS 연결을 프록시하는 데 필요한 하나 이상의 추가 CA 인증서입니다.

정보를 검토하고 선택적으로 클러스터를 생성하기 전에 사용자 지정할 때 YAML 스위치를 클릭하여 패널의 install-config.yaml 파일 콘텐츠를 볼 수 있습니다. 업데이트가 있는 경우 사용자 지정 설정으로 YAML 파일을 편집할 수 있습니다.

Kubernetes용 Red Hat Advanced Cluster Management를 사용하고 관리 클러스터 klusterlet을 특정 노드에서 실행하도록 구성하려면 선택 사항: 필요한 단계를 위해 특정 노드에서 실행되도록 klusterlet 구성 을 참조하십시오.

참고: 클러스터를 가져오기 위해 클러스터 세부 정보가 제공된 oc 명령을 실행할 필요가 없습니다. 클러스터를 생성할 때 다중 클러스터 엔진 Operator 관리 아래에 자동으로 구성됩니다.

클러스터에 액세스하는 방법에 대한 지침은 클러스터 액세스를 계속합니다.

1.5.4.6. Google Cloud Platform에서 클러스터 생성

GCP(Google Cloud Platform)에 Red Hat OpenShift Container Platform 클러스터를 생성하려면 절차를 따르십시오. GCP에 대한 자세한 내용은 Google Cloud Platform 을 참조하십시오.

클러스터를 생성할 때 생성 프로세스는 OpenShift Container Platform 설치 프로그램을 Hive 리소스와 함께 사용합니다. 이 절차를 완료한 후 클러스터 생성에 대한 질문이 있는 경우 OpenShift Container Platform 설명서의 GCP에 프로세스에 대한 자세한 내용은 설치를 참조하십시오.

1.5.4.6.1. 사전 요구 사항

GCP에서 클러스터를 생성하기 전에 다음 사전 요구 사항을 참조하십시오.

- 배포된 허브 클러스터가 있어야 합니다.

- GCP 인증 정보가 있어야 합니다. 자세한 내용은 Google Cloud Platform의 인증 정보 생성을 참조하십시오.

- GCP에 구성된 도메인이 있어야 합니다. 도메인 구성 방법에 대한 지침은 사용자 정의 도메인 설정을 참조하십시오.

- 사용자 이름과 암호가 포함된 GCP 로그인 인증 정보가 필요합니다.

- OpenShift Container Platform 이미지 풀 시크릿이 있어야 합니다. 이미지 풀 시크릿 사용을 참조하십시오.

참고: 클라우드 공급자의 클라우드 공급자 액세스 키를 변경하는 경우 다중 클러스터 엔진 Operator 콘솔에서 클라우드 공급자에 대한 해당 인증 정보도 수동으로 업데이트해야 합니다. 이는 관리 클러스터가 호스팅되는 클라우드 공급자에서 인증 정보가 만료되고 관리 클러스터를 삭제하려고 할 때 필요합니다.

1.5.4.6.2. 콘솔을 사용하여 클러스터 생성

다중 클러스터 엔진 Operator 콘솔에서 클러스터를 생성하려면 Infrastructure > Clusters 로 이동합니다. 클러스터 페이지에서 클러스터 생성 을 클릭하고 콘솔의 단계를 완료합니다.

참고: 이 절차는 클러스터를 생성하기 위한 것입니다. 가져올 기존 클러스터가 있는 경우 해당 단계에 대한 클러스터 가져오기 를 참조하십시오.

인증 정보를 생성해야 하는 경우 자세한 내용은 Google Cloud Platform의 인증 정보 생성 을 참조하십시오.

클러스터 이름은 클러스터의 호스트 이름에 사용됩니다. GCP 클러스터 이름 지정에 적용되는 몇 가지 제한 사항이 있습니다. 이러한 제한에는 goog 로 이름을 시작하거나 이름에 Google 과 유사한 문자 및 숫자 그룹이 포함되어 있지 않습니다. 전체 제한 목록은 버킷 이름 지정 지침을 참조하십시오.

중요: 클러스터를 생성할 때 컨트롤러는 클러스터 및 해당 리소스에 대한 네임스페이스를 생성합니다. 해당 네임스페이스에 해당 클러스터 인스턴스의 리소스만 포함해야 합니다. 클러스터를 삭제하면 네임스페이스와 모든 리소스가 삭제됩니다.

팁: 콘솔에서 정보를 입력할 때 콘텐츠 업데이트를 보려면 YAML 을 선택합니다.

기존 클러스터 세트에 클러스터를 추가하려면 클러스터에 추가하려면 클러스터에 대한 올바른 권한이 있어야 합니다. 클러스터를 생성할 때 cluster-admin 권한이 없는 경우 clusterset-admin 권한이 있는 클러스터 세트를 선택해야 합니다. 지정된 클러스터 세트에 대한 올바른 권한이 없는 경우 클러스터 생성에 실패합니다. 선택할 클러스터 설정 옵션이 없는 경우 클러스터 세트에 clusterset-admin 권한을 제공하려면 클러스터 관리자에게 문의하십시오.

모든 관리 클러스터는 관리 클러스터 세트와 연결되어 있어야 합니다. ManagedClusterSet 에 관리 클러스터를 할당하지 않으면 기본 관리 클러스터 세트에 자동으로 추가됩니다.

GCP 계정에 대해 선택한 인증 정보와 연결된 기본 DNS 도메인이 이미 있는 경우 해당 값이 필드에 채워집니다. 값을 덮어 쓰기하여 변경할 수 있습니다. 자세한 내용은 사용자 정의 도메인 설정을 참조하십시오. 이 이름은 클러스터의 호스트 이름에 사용됩니다.

릴리스 이미지는 클러스터를 생성하는 데 사용되는 OpenShift Container Platform 이미지의 버전을 식별합니다. 사용하려는 버전을 사용할 수 있는 경우 이미지 목록에서 이미지를 선택할 수 있습니다. 사용하려는 이미지가 표준 이미지가 아닌 경우 사용하려는 이미지의 URL을 입력할 수 있습니다. 릴리스 이미지에 대한 자세한 내용은 릴리스 이미지 릴리스를 참조하십시오.

노드 풀에는 컨트롤 플레인 풀과 작업자 풀이 포함됩니다. 컨트롤 플레인 노드는 클러스터 활동 관리를 공유합니다. 정보에는 다음 필드가 포함됩니다.

- region: 컨트롤 플레인 풀을 실행할 리전을 지정합니다. 가까운 리전은 더 빠른 성능을 제공할 수 있지만 더 멀리 있는 영역이 더 분산될 수 있습니다.

- CPU 아키텍처: 관리 클러스터의 아키텍처 유형이 허브 클러스터의 아키텍처와 동일하지 않으면 풀에 있는 시스템의 명령 집합 아키텍처 값을 입력합니다. 유효한 값은 amd64,ppc64le,s390x 및 arm64 입니다.

컨트롤 플레인 풀의 인스턴스 유형을 지정할 수 있습니다. 인스턴스 유형 및 크기를 생성한 후 변경할 수 있습니다.

작업자 풀에서 하나 이상의 작업자 노드를 생성하여 클러스터의 컨테이너 워크로드를 실행할 수 있습니다. 단일 작업자 풀에 있거나 여러 작업자 풀에 배포할 수 있습니다. 제로 작업자 노드가 지정되면 컨트롤 플레인 노드도 작업자 노드로 작동합니다. 정보에는 다음 필드가 포함됩니다.

- 인스턴스 유형: 인스턴스 유형을 만든 후 인스턴스의 유형과 크기를 변경할 수 있습니다.

- 노드 수: 이 설정은 작업자 풀을 정의할 때 필요합니다.

네트워킹 세부 정보가 필요하며 IPv6 주소를 사용하려면 여러 네트워크가 필요합니다. 네트워크 추가를 클릭하여 추가 네트워크를 추가할 수 있습니다.

인증 정보에 제공된 프록시 정보는 프록시 필드에 자동으로 추가됩니다. 정보를 그대로 사용하거나, 덮어쓰거나 프록시를 활성화하려면 정보를 추가할 수 있습니다. 다음 목록에는 프록시를 생성하는 데 필요한 정보가 포함되어 있습니다.

-

HTTP 프록시:

HTTP트래픽의 프록시로 사용해야 하는 URL입니다. -

HTTPS 프록시:

HTTPS트래픽에 사용해야 하는 보안 프록시 URL입니다. 값을 제공하지 않으면 HTTP 및HTTPS모두에HTTP프록시 URL -

프록시 사이트 없음: 프록시를 바이패스해야 하는 쉼표로 구분된 사이트 목록입니다. 마침표로 도메인 이름을 시작합니다

.를 해당 도메인에 있는 모든 하위 도메인을 포함합니다. 모든 대상에 대해 프록시를 바이패스하려면 별표*를 추가합니다. - 추가 신뢰 번들: HTTPS 연결을 프록시하는 데 필요한 하나 이상의 추가 CA 인증서입니다.

정보를 검토하고 선택적으로 클러스터를 생성하기 전에 사용자 지정할 때 YAML: On 을 선택하여 패널의 install-config.yaml 파일 콘텐츠를 볼 수 있습니다. 업데이트가 있는 경우 사용자 지정 설정으로 YAML 파일을 편집할 수 있습니다.

Kubernetes용 Red Hat Advanced Cluster Management를 사용하고 관리 클러스터 klusterlet을 특정 노드에서 실행하도록 구성하려면 선택 사항: 필요한 단계를 위해 특정 노드에서 실행되도록 klusterlet 구성 을 참조하십시오.

참고: 클러스터를 가져오기 위해 클러스터 세부 정보가 제공된 oc 명령을 실행할 필요가 없습니다. 클러스터를 생성할 때 다중 클러스터 엔진 Operator 관리 아래에 자동으로 구성됩니다.

클러스터에 액세스하는 방법에 대한 지침은 클러스터 액세스를 계속합니다.

1.5.4.7. VMware vSphere에서 클러스터 생성

다중 클러스터 엔진 Operator 콘솔을 사용하여 VMware vSphere에 Red Hat OpenShift Container Platform 클러스터를 배포할 수 있습니다.

클러스터를 생성할 때 생성 프로세스는 OpenShift Container Platform 설치 프로그램을 Hive 리소스와 함께 사용합니다. 이 절차를 완료한 후 클러스터 생성에 대한 질문이 있는 경우 OpenShift Container Platform 설명서의 vSphere에 프로세스에 대한 자세한 내용은 설치를 참조하십시오.

1.5.4.7.1. 사전 요구 사항

vSphere에서 클러스터를 생성하기 전에 다음 사전 요구 사항을 참조하십시오.

- OpenShift Container Platform 버전 4.13 이상에 배포된 허브 클러스터가 있어야 합니다.

- vSphere 인증 정보가 필요합니다. 자세한 내용은 VMware vSphere의 인증 정보 생성 을 참조하십시오.

- OpenShift Container Platform 이미지 풀 시크릿이 필요합니다. 이미지 풀 시크릿 사용을 참조하십시오.

배포 중인 VMware 인스턴스에 대한 다음 정보가 있어야 합니다.

- API 및 Ingress 인스턴스에 필요한 고정 IP 주소

DNS 레코드:

다음 API 기본 도메인은 정적 API VIP를 가리켜야 합니다.

api.<cluster_name>.<base_domain>다음 애플리케이션 기본 도메인은 Ingress VIP의 고정 IP 주소를 가리켜야 합니다.

*.apps.<cluster_name>.<base_domain>

1.5.4.7.2. 콘솔을 사용하여 클러스터 생성

다중 클러스터 엔진 Operator 콘솔에서 클러스터를 생성하려면 Infrastructure > Clusters 로 이동합니다. 클러스터 페이지에서 클러스터 생성 을 클릭하고 콘솔의 단계를 완료합니다.

참고: 이 절차는 클러스터를 생성하기 위한 것입니다. 가져올 기존 클러스터가 있는 경우 해당 단계에 대한 클러스터 가져오기 를 참조하십시오.

인증 정보를 생성해야 하는 경우 인증 정보 생성에 대한 자세한 내용은 VMware vSphere의 인증 정보 생성 을 참조하십시오.

클러스터 이름은 클러스터의 호스트 이름에 사용됩니다.

중요: 클러스터를 생성할 때 컨트롤러는 클러스터 및 해당 리소스에 대한 네임스페이스를 생성합니다. 해당 네임스페이스에 해당 클러스터 인스턴스의 리소스만 포함해야 합니다. 클러스터를 삭제하면 네임스페이스와 모든 리소스가 삭제됩니다.

팁: 콘솔에서 정보를 입력할 때 콘텐츠 업데이트를 보려면 YAML 을 선택합니다.

기존 클러스터 세트에 클러스터를 추가하려면 클러스터에 추가하려면 클러스터에 대한 올바른 권한이 있어야 합니다. 클러스터를 생성할 때 cluster-admin 권한이 없는 경우 clusterset-admin 권한이 있는 클러스터 세트를 선택해야 합니다. 지정된 클러스터 세트에 대한 올바른 권한이 없는 경우 클러스터 생성에 실패합니다. 선택할 클러스터 설정 옵션이 없는 경우 클러스터 세트에 clusterset-admin 권한을 제공하려면 클러스터 관리자에게 문의하십시오.

모든 관리 클러스터는 관리 클러스터 세트와 연결되어 있어야 합니다. ManagedClusterSet 에 관리 클러스터를 할당하지 않으면 기본 관리 클러스터 세트에 자동으로 추가됩니다.

vSphere 계정에 대해 구성한 선택한 인증 정보와 연결된 기본 도메인이 이미 있는 경우 해당 값이 필드에 채워집니다. 값을 덮어 쓰기하여 변경할 수 있습니다. 자세한 내용은 사용자 지정으로 vSphere에 클러스터 설치를 참조하십시오. 이 값은 사전 요구 사항 섹션에 나열된 DNS 레코드를 생성하는 데 사용한 이름과 일치해야 합니다. 이 이름은 클러스터의 호스트 이름에 사용됩니다.

릴리스 이미지는 클러스터를 생성하는 데 사용되는 OpenShift Container Platform 이미지의 버전을 식별합니다. 사용하려는 버전을 사용할 수 있는 경우 이미지 목록에서 이미지를 선택할 수 있습니다. 사용하려는 이미지가 표준 이미지가 아닌 경우 사용하려는 이미지의 URL을 입력할 수 있습니다. 릴리스 이미지에 대한 자세한 내용은 릴리스 이미지 릴리스를 참조하십시오.

참고: OpenShift Container Platform 버전 4.13 이상의 릴리스 이미지가 지원됩니다.

노드 풀에는 컨트롤 플레인 풀과 작업자 풀이 포함됩니다. 컨트롤 플레인 노드는 클러스터 활동 관리를 공유합니다. 정보에는 CPU 아키텍처 필드가 포함됩니다. 다음 필드 설명을 표시합니다.

- CPU 아키텍처: 관리 클러스터의 아키텍처 유형이 허브 클러스터의 아키텍처와 동일하지 않으면 풀에 있는 시스템의 명령 집합 아키텍처 값을 입력합니다. 유효한 값은 amd64,ppc64le,s390x 및 arm64 입니다.

작업자 풀에서 하나 이상의 작업자 노드를 생성하여 클러스터의 컨테이너 워크로드를 실행할 수 있습니다. 단일 작업자 풀에 있거나 여러 작업자 풀에 배포할 수 있습니다. 제로 작업자 노드가 지정되면 컨트롤 플레인 노드도 작업자 노드로 작동합니다. 정보에는 소켓당 코어,CPU,Memory_min MiB, _Disk 크기 (GiB) 및 노드 수가 포함됩니다.

네트워킹 정보가 필요합니다. IPv6를 사용하려면 여러 네트워크가 필요합니다. 필수 네트워킹 정보 중 일부는 다음 필드를 포함합니다.

- vSphere 네트워크 이름: VMware vSphere 네트워크 이름을 지정합니다.

API VIP: 내부 API 통신에 사용할 IP 주소를 지정합니다.

참고: 이 값은 사전 요구 사항 섹션에 나열된 DNS 레코드를 생성하는 데 사용한 이름과 일치해야 합니다. 제공되지 않는 경우

api.가 올바르게 확인되도록 DNS를 사전 구성해야 합니다.Ingress VIP: 인그레스 트래픽에 사용할 IP 주소를 지정합니다.

참고: 이 값은 사전 요구 사항 섹션에 나열된 DNS 레코드를 생성하는 데 사용한 이름과 일치해야 합니다. 제공되지 않는 경우

test.apps.가 올바르게 확인되도록 DNS를 사전 구성해야 합니다.

네트워크 추가를 클릭하여 추가 네트워크를 추가할 수 있습니다. IPv6 주소를 사용하는 경우 두 개 이상의 네트워크가 있어야 합니다.

인증 정보에 제공된 프록시 정보는 프록시 필드에 자동으로 추가됩니다. 정보를 그대로 사용하거나, 덮어쓰거나 프록시를 활성화하려면 정보를 추가할 수 있습니다. 다음 목록에는 프록시를 생성하는 데 필요한 정보가 포함되어 있습니다.

-

HTTP 프록시:

HTTP트래픽의 프록시로 사용해야 하는 URL을 지정합니다. -

HTTPS 프록시:

HTTPS트래픽에 사용해야 하는 보안 프록시 URL을 지정합니다. 값을 제공하지 않으면 HTTP 및HTTPS모두에HTTP프록시 URL -

프록시 사이트 없음: 프록시를 바이패스해야 하는 쉼표로 구분된 사이트 목록을 제공합니다. 마침표로 도메인 이름을 시작합니다

.를 해당 도메인에 있는 모든 하위 도메인을 포함합니다. 모든 대상에 대해 프록시를 바이패스하려면 별표*를 추가합니다. - 추가 신뢰 번들: HTTPS 연결을 프록시하는 데 필요한 하나 이상의 추가 CA 인증서입니다.

Disconnected installation 을 클릭하여 연결이 끊긴 설치를 정의합니다. VMware vSphere 공급자 및 연결이 끊긴 설치를 사용하여 클러스터를 생성할 때 미러 레지스트리에 액세스하는 데 인증서가 필요한 경우 인증 정보를 구성할 때 구성 섹션의 추가 신뢰 번들 필드에 또는 클러스터를 생성할 때 연결 해제된 설치 섹션에 입력해야 합니다.

자동화 템플릿 추가를 클릭하여 템플릿을 생성할 수 있습니다.

정보를 검토하고 선택적으로 클러스터를 생성하기 전에 사용자 지정할 때 YAML 스위치를 클릭하여 패널의 install-config.yaml 파일 콘텐츠를 볼 수 있습니다. 업데이트가 있는 경우 사용자 지정 설정으로 YAML 파일을 편집할 수 있습니다.

Kubernetes용 Red Hat Advanced Cluster Management를 사용하고 관리 클러스터 klusterlet을 특정 노드에서 실행하도록 구성하려면 선택 사항: 필요한 단계를 위해 특정 노드에서 실행되도록 klusterlet 구성 을 참조하십시오.

참고: 클러스터를 가져오기 위해 클러스터 세부 정보가 제공된 oc 명령을 실행할 필요가 없습니다. 클러스터를 생성할 때 다중 클러스터 엔진 Operator 관리 아래에 자동으로 구성됩니다.

클러스터에 액세스하는 방법에 대한 지침은 클러스터 액세스를 계속합니다.

1.5.4.8. Red Hat OpenStack Platform에서 클러스터 생성

다중 클러스터 엔진 Operator 콘솔을 사용하여 Red Hat OpenStack Platform에 Red Hat OpenShift Container Platform 클러스터를 배포할 수 있습니다.

클러스터를 생성할 때 생성 프로세스는 OpenShift Container Platform 설치 프로그램을 Hive 리소스와 함께 사용합니다. 이 절차를 완료한 후 클러스터 생성에 대한 질문이 있는 경우 OpenShift Container Platform 설명서의 OpenStack에 프로세스에 대한 자세한 내용은 설치를 참조하십시오.

1.5.4.8.1. 사전 요구 사항

Red Hat OpenStack Platform에서 클러스터를 생성하기 전에 다음 사전 요구 사항을 참조하십시오.

- OpenShift Container Platform 버전 4.6 이상에 배포된 허브 클러스터가 있어야 합니다.

- Red Hat OpenStack Platform 인증 정보가 있어야 합니다. 자세한 내용은 Red Hat OpenStack Platform의 인증 정보 생성을 참조하십시오.

- OpenShift Container Platform 이미지 풀 시크릿이 필요합니다. 이미지 풀 시크릿 사용을 참조하십시오.

배포 중인 Red Hat OpenStack Platform 인스턴스에 대한 다음 정보가 필요합니다.

-

컨트롤 플레인 및 작업자 인스턴스의 플레이버 이름(예:

m1.xlarge) - 유동 IP 주소를 제공하는 외부 네트워크의 네트워크 이름

- API 및 수신 인스턴스에 필요한 유동 IP 주소

DNS 레코드:

다음 API 기본 도메인은 API의 유동 IP 주소를 가리켜야 합니다.

api.<cluster_name>.<base_domain>다음 애플리케이션 기본 도메인은 ingress:app-name의 유동 IP 주소를 가리켜야 합니다.

*.apps.<cluster_name>.<base_domain>

-

컨트롤 플레인 및 작업자 인스턴스의 플레이버 이름(예:

1.5.4.8.2. 콘솔을 사용하여 클러스터 생성

다중 클러스터 엔진 Operator 콘솔에서 클러스터를 생성하려면 Infrastructure > Clusters 로 이동합니다. 클러스터 페이지에서 클러스터 생성 을 클릭하고 콘솔의 단계를 완료합니다.

참고: 이 절차는 클러스터를 생성하기 위한 것입니다. 가져올 기존 클러스터가 있는 경우 해당 단계에 대한 클러스터 가져오기 를 참조하십시오.

인증 정보를 생성해야 하는 경우 자세한 내용은 Red Hat OpenStack Platform의 인증 정보 생성 을 참조하십시오.

클러스터 이름은 클러스터의 호스트 이름에 사용됩니다. 이름에는 15자 미만이 포함되어야 합니다. 이 값은 인증 정보 사전 요구 사항 섹션에 나열된 DNS 레코드를 생성하는 데 사용한 이름과 일치해야 합니다.

중요: 클러스터를 생성할 때 컨트롤러는 클러스터 및 해당 리소스에 대한 네임스페이스를 생성합니다. 해당 네임스페이스에 해당 클러스터 인스턴스의 리소스만 포함해야 합니다. 클러스터를 삭제하면 네임스페이스와 모든 리소스가 삭제됩니다.

팁: 콘솔에서 정보를 입력할 때 콘텐츠 업데이트를 보려면 YAML 을 선택합니다.

기존 클러스터 세트에 클러스터를 추가하려면 클러스터에 추가하려면 클러스터에 대한 올바른 권한이 있어야 합니다. 클러스터를 생성할 때 cluster-admin 권한이 없는 경우 clusterset-admin 권한이 있는 클러스터 세트를 선택해야 합니다. 지정된 클러스터 세트에 대한 올바른 권한이 없는 경우 클러스터 생성에 실패합니다. 선택할 클러스터 설정 옵션이 없는 경우 클러스터 세트에 clusterset-admin 권한을 제공하려면 클러스터 관리자에게 문의하십시오.

모든 관리 클러스터는 관리 클러스터 세트와 연결되어 있어야 합니다. ManagedClusterSet 에 관리 클러스터를 할당하지 않으면 기본 관리 클러스터 세트에 자동으로 추가됩니다.

Red Hat OpenStack Platform 계정에 대해 구성한 선택한 인증 정보와 연결된 기본 DNS 도메인이 이미 있는 경우 해당 값이 필드에 채워집니다. 값을 덮어 쓰기하여 변경할 수 있습니다. 자세한 내용은 Red Hat OpenStack Platform 설명서의 도메인 관리를 참조하십시오. 이 이름은 클러스터의 호스트 이름에 사용됩니다.

릴리스 이미지는 클러스터를 생성하는 데 사용되는 OpenShift Container Platform 이미지의 버전을 식별합니다. 사용하려는 버전을 사용할 수 있는 경우 이미지 목록에서 이미지를 선택할 수 있습니다. 사용하려는 이미지가 표준 이미지가 아닌 경우 사용하려는 이미지의 URL을 입력할 수 있습니다. 릴리스 이미지에 대한 자세한 내용은 릴리스 이미지 릴리스를 참조하십시오. OpenShift Container Platform 버전 4.6.x 이상의 릴리스 이미지만 지원됩니다.

노드 풀에는 컨트롤 플레인 풀과 작업자 풀이 포함됩니다. 컨트롤 플레인 노드는 클러스터 활동 관리를 공유합니다. 관리 클러스터의 아키텍처 유형이 허브 클러스터의 아키텍처와 동일하지 않은 경우 풀에 있는 시스템의 명령 집합 아키텍처 값을 입력합니다. 유효한 값은 amd64,ppc64le,s390x 및 arm64 입니다.

컨트롤 플레인 풀에 인스턴스 유형을 추가해야 하지만 생성된 후 인스턴스의 유형과 크기를 변경할 수 있습니다.

작업자 풀에서 하나 이상의 작업자 노드를 생성하여 클러스터의 컨테이너 워크로드를 실행할 수 있습니다. 단일 작업자 풀에 있거나 여러 작업자 풀에 배포할 수 있습니다. 제로 작업자 노드가 지정되면 컨트롤 플레인 노드도 작업자 노드로 작동합니다. 정보에는 다음 필드가 포함됩니다.

- 인스턴스 유형: 인스턴스 유형을 만든 후 인스턴스의 유형과 크기를 변경할 수 있습니다.

- 노드 수: 작업자 풀의 노드 수를 지정합니다. 이 설정은 작업자 풀을 정의할 때 필요합니다.

클러스터에 네트워킹 세부 정보가 필요합니다. IPv4 네트워크에 대해 하나 이상의 네트워크에 대한 값을 제공해야 합니다. IPv6 네트워크의 경우 둘 이상의 네트워크를 정의해야 합니다.

네트워크 추가를 클릭하여 추가 네트워크를 추가할 수 있습니다. IPv6 주소를 사용하는 경우 두 개 이상의 네트워크가 있어야 합니다.

인증 정보에 제공된 프록시 정보는 프록시 필드에 자동으로 추가됩니다. 정보를 그대로 사용하거나, 덮어쓰거나 프록시를 활성화하려면 정보를 추가할 수 있습니다. 다음 목록에는 프록시를 생성하는 데 필요한 정보가 포함되어 있습니다.

-

HTTP 프록시:

HTTP트래픽의 프록시로 사용해야 하는 URL을 지정합니다. -

HTTPS 프록시:

HTTPS트래픽에 사용해야 하는 보안 프록시 URL입니다. 값을 제공하지 않으면 HTTP 및HTTPS모두에HTTP프록시 -

프록시 없음: 프록시를 바이패스해야 하는 쉼표로 구분된 사이트 목록을 정의합니다. 마침표로 도메인 이름을 시작합니다

.를 해당 도메인에 있는 모든 하위 도메인을 포함합니다. 모든 대상에 대해 프록시를 바이패스하려면 별표*를 추가합니다. - 추가 신뢰 번들: HTTPS 연결을 프록시하는 데 필요한 하나 이상의 추가 CA 인증서입니다.

연결 해제된 설치를 클릭하여 연결 해제된 설치 이미지를 정의할 수 있습니다. Red Hat OpenStack Platform 공급자 및 연결이 끊긴 설치를 사용하여 클러스터를 생성할 때 인증서가 미러 레지스트리에 액세스해야 하는 경우, 클러스터를 생성할 때 연결 해제된 설치 구성 섹션의 추가 신뢰 번들 필드에 입력해야 합니다.

정보를 검토하고 선택적으로 클러스터를 생성하기 전에 사용자 지정할 때 YAML 스위치를 클릭하여 패널의 install-config.yaml 파일 콘텐츠를 볼 수 있습니다. 업데이트가 있는 경우 사용자 지정 설정으로 YAML 파일을 편집할 수 있습니다.

내부 CA(인증 기관)를 사용하는 클러스터를 생성할 때 다음 단계를 완료하여 클러스터의 YAML 파일을 사용자 지정해야 합니다.

검토 단계에서 YAML 스위치를 사용하여 CA 인증서 번들로 목록 상단에