Ingress と負荷分散

OpenShift Container Platform でサービスを公開し、外部トラフィックを管理する

概要

第1章 ルート

1.1. 基本ルートの作成

暗号化されていない HTTP がある場合は、ルートオブジェクトを使用して基本ルートを作成できます。

1.1.1. HTTP ベースのルートの作成

hello-openshift アプリケーションを例として、以下の手順で Web アプリケーションへの単純な HTTP ベースのルートを作成できます。

公開 URL でアプリケーションをホストするルートを作成できます。ルートは、アプリケーションのネットワークセキュリティー設定に応じて、セキュリティーで保護される場合と保護されない場合があります。HTTP ベースのルートとは、セキュアではないルートで、基本的な HTTP ルーティングプロトコルを使用してセキュリティー保護されていないアプリケーションポートでサービスを公開します。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 - 管理者としてログインしている。

- あるポートを公開する Web アプリケーションと、そのポートでトラフィックをリッスンする TCP エンドポイントがあります。

手順

次のコマンドを実行して、

hello-openshiftというプロジェクトを作成します。$ oc new-project hello-openshift以下のコマンドを実行してプロジェクトに Pod を作成します。

$ oc create -f https://raw.githubusercontent.com/openshift/origin/master/examples/hello-openshift/hello-pod.json以下のコマンドを実行して、

hello-openshiftというサービスを作成します。$ oc expose pod/hello-openshift次のコマンドを実行して、

hello-openshiftアプリケーションに対して、セキュアではないルートを作成します。$ oc expose svc hello-openshift

検証

作成した

routeリソースを確認するには、次のコマンドを実行します。$ oc get routes -o yaml hello-openshift作成したセキュアでないルートの YAML 定義例

apiVersion: route.openshift.io/v1 kind: Route metadata: name: hello-openshift spec: host: www.example.com port: targetPort: 8080 to: kind: Service name: hello-openshiftここでは、以下のようになります。

host-

サービスを指すエイリアス DNS レコードを指定します。このフィールドには、

www.example.comなどの有効な DNS 名を指定できます。DNS 名は DNS952 サブドメイン規則に従う必要があります。指定しない場合は、ルート名が自動的に生成されます。 targetPortこのルートが指すサービスによって選択される Pod のターゲットポートを指定します。

注記デフォルトの Ingress ドメインを表示するには、以下のコマンドを実行します。

$ oc get ingresses.config/cluster -o jsonpath={.spec.domain}

1.1.2. パスベースのルート

単一のホスト名を使用して複数のアプリケーションにサービスを提供するには、パスベースのルーティングを設定します。この HTTP ベースの設定では、URL パスコンポーネントを比較することでトラフィックを特定のサービスに振り分け、リクエストが定義された最も具体的なルートと一致するようにします。

以下の表は、ルートのサンプルおよびそれらのアクセシビリティーを示しています。

| ルート | 比較すると | アクセス可能 |

|---|---|---|

| www.example.com/test | www.example.com/test | はい |

| www.example.com | いいえ | |

| www.example.com/test および www.example.com | www.example.com/test | はい |

| www.example.com | はい | |

| www.example.com | www.example.com/text | Yes (ルートではなく、ホストで一致) |

| www.example.com | はい |

パスを持つ保護されていないルートの例

apiVersion: route.openshift.io/v1

kind: Route

metadata:

name: route-unsecured

spec:

host: www.example.com

path: "/test"

to:

kind: Service

name: service-name-

spec.host: パスベースのルートのパス属性を指定します。

ルーターは TLS を終了させず、要求のコンテンツを読み込みことができないので、パスベースのルーティングは、passthrough TLS を使用する場合には利用できません。

1.1.3. Ingress Controller シャーディングのルート作成

ルートを使用すると、アプリケーションを URL でホストできます。Ingress Controller のシャーディングは、一連の Ingress Controller 間での着信トラフィック負荷のバランスをとるのに役立ちます。Ingress Controller のシャーディング機能を使用すると、トラフィックを特定の Ingress Controller に分離することもできます。たとえば、Company A のトラフィックをある Ingress Controller に指定し、Company B を別の Ingress Controller に指定できます。

以下の手順では、例として hello-openshift アプリケーションを使用して、Ingress Controller シャーディングのルートを作成する方法を説明します。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 - プロジェクト管理者としてログインしている。

- ポートを公開する Web アプリケーションと、そのポート上のトラフィックをリッスンする HTTP または TLS エンドポイントがある。

- シャーディング用に Ingress Controller を設定している。

手順

次のコマンドを実行して、

hello-openshiftというプロジェクトを作成します。$ oc new-project hello-openshift以下のコマンドを実行してプロジェクトに Pod を作成します。

$ oc create -f https://raw.githubusercontent.com/openshift/origin/master/examples/hello-openshift/hello-pod.json以下のコマンドを実行して、

hello-openshiftというサービスを作成します。$ oc expose pod/hello-openshifthello-openshift-route.yamlというルート定義を作成します。シャーディング用に作成したルートの YAML 定義

apiVersion: route.openshift.io/v1 kind: Route metadata: labels: type: sharded name: hello-openshift-edge namespace: hello-openshift spec: subdomain: hello-openshift tls: termination: edge to: kind: Service name: hello-openshiftここでは、以下のようになります。

type-

ラベルキーとその対応するラベル値は、Ingress Controller で指定されたものと一致する必要があることを指定します。この例では、Ingress Controller にはラベルキーと値

type: shardedがあります。 subdomain-

サブドメインフィールドの値を使用して公開されるルートを指定します。subdomainフィールドを指定するときは、ホスト名を未設定のままにしておく必要があります。ホストフィールドとサブドメインフィールドの両方を指定した場合、ルートはホストフィールドの値を使用し、サブドメインフィールドは無視します。

次のコマンドを実行し、

hello-openshift-route.yamlを使用してhello-openshiftアプリケーションへのルートを作成します。$ oc -n hello-openshift create -f hello-openshift-route.yaml

検証

次のコマンドを使用して、ルートのステータスを取得します。

$ oc -n hello-openshift get routes/hello-openshift-edge -o yaml結果の

Routeリソースは次のようになります。出力例

apiVersion: route.openshift.io/v1 kind: Route metadata: labels: type: sharded name: hello-openshift-edge namespace: hello-openshift spec: subdomain: hello-openshift tls: termination: edge to: kind: Service name: hello-openshift status: ingress: - host: hello-openshift.<apps-sharded.basedomain.example.net> routerCanonicalHostname: router-sharded.<apps-sharded.basedomain.example.net> routerName: shardedここでは、以下のようになります。

host-

イングレスコントローラー (ルーター) がルートを公開するために使用するホスト名を指定します。

hostフィールドの値は、Ingress Controller によって自動的に決定され、そのドメインを使用します。この例では、Ingress Controller のドメインは<apps-sharded.basedomain.example.net>です。 <apps-sharded.basedomain.example.net>- Ingress コントローラーのホスト名を指定します。ホスト名が設定されていない場合、ルートは代わりにサブドメインを使用できます。サブドメインを指定すると、ルートを公開する Ingress Controller のドメインが自動的に使用されます。ルートが複数の Ingress Controller によって公開される場合、ルートは複数の URL でホストされます。

routerName-

Ingress コントローラーの名前を指定します。この例では、Ingress Controller の名前は

shardedです。

1.1.4. Ingress オブジェクトを使用したルートの作成

Ingress リソースを必要とするエコシステムコンポーネントを統合するには、Ingress オブジェクトを設定します。OpenShift Container Platform は、対応するルートオブジェクトのライフサイクルを自動的に管理し、シームレスな接続を確保するためにルートオブジェクトを作成および削除します。

手順

OpenShift Container Platform コンソールで Ingress オブジェクトを定義するか、

oc createコマンドを実行します。Ingress の YAML 定義

apiVersion: networking.k8s.io/v1 kind: Ingress metadata: name: frontend annotations: route.openshift.io/termination: "reencrypt" route.openshift.io/destination-ca-certificate-secret: secret-ca-cert spec: rules: - host: www.example.com http: paths: - backend: service: name: frontend port: number: 443 path: / pathType: Prefix tls: - hosts: - www.example.com secretName: example-com-tls-certificate # ...ここでは、以下のようになります。

route.openshift.io/termination-

route.openshift.io/terminationアノテーションを指定します。Ingress にはこのパラメーターがないため、Routeのspec.tls.terminationパラメーターを設定できます。受け入れられる値は、edge、passthrough、reencryptです。その他のすべての値は警告なしに無視されます。アノテーション値が設定されていない場合は、edgeがデフォルトルートになります。デフォルトの edge ルートを実装するには、TLS 証明書の詳細をテンプレートファイルで定義する必要があります。 ルールホスト-

Ingressオブジェクトのホスト名を明示的に指定します。必須パラメーター。<host_name>.<cluster_ingress_domain>構文 (apps.openshiftdemos.comなど) を使用して、*.<cluster_ingress_domain>ワイルドカード DNS レコードとクラスターのサービング証明書を利用できます。それ以外の場合は、選択したホスト名の DNS レコードがあることを確認する必要があります。 宛先 CA 証明書シークレットroute.openshift.io/destination-ca-certificate-secretアノテーションを指定します。このアノテーションは、Ingress オブジェクトで使用して、カスタム宛先証明書 (CA) を使用したルートを定義するために使用できます。アノテーションは、生成されたルートに挿入される kubernetes シークレットsecret-ca-certを参照します。route.openshift.io/terminationアノテーションでpassthroughの値を指定する場合は、仕様でpathを''に設定し、pathTypeをImplementationSpecificに設定します。apiVersion: networking.k8s.io/v1 kind: Ingress # ... spec: rules: - host: www.example.com http: paths: - path: '' pathType: ImplementationSpecific backend: service: name: frontend port: number: 443 # ...$ oc apply -f ingress.yaml-

Ingress オブジェクトから宛先 CA を使用してルートオブジェクトを指定するには、シークレットの

data.tls.crt指定子に PEM エンコード形式の証明書を使用してkubernetes.io/tlsまたはOpaqueタイプのシークレットを作成する必要があります。

ルートを一覧表示します。

$ oc get routes結果には、

frontend-で始まる名前の自動生成ルートが含まれます。NAME HOST/PORT PATH SERVICES PORT TERMINATION WILDCARD frontend-gnztq www.example.com frontend 443 reencrypt/Redirect None自動生成されたルートの YAML 定義例

apiVersion: route.openshift.io/v1 kind: Route metadata: name: frontend-gnztq ownerReferences: - apiVersion: networking.k8s.io/v1 controller: true kind: Ingress name: frontend uid: 4e6c59cc-704d-4f44-b390-617d879033b6 spec: host: www.example.com path: / port: targetPort: https tls: certificate: | -----BEGIN CERTIFICATE----- [...] -----END CERTIFICATE----- insecureEdgeTerminationPolicy: Redirect key: | -----BEGIN RSA PRIVATE KEY----- [...] -----END RSA PRIVATE KEY----- termination: reencrypt destinationCACertificate: | -----BEGIN CERTIFICATE----- [...] -----END CERTIFICATE----- to: kind: Service name: frontend

1.2. ルートの保護

HTTP Strict Transport Security (HSTS) を使用してルートを保護できます。

1.2.1. HTTP Strict Transport Security

セキュリティーを強化し、ウェブサイトのパフォーマンスを最適化するには、HTTP Strict Transport Security (HSTS) ポリシーを使用してください。この仕組みにより、ブラウザーはルートホスト上で HTTPS トラフィックのみを使用するように指示され、HTTP リダイレクトの必要性がなくなり、ユーザー操作が高速化されます。

HSTS ポリシーが適用されると、HSTS はサイトから Strict Transport Security ヘッダーを HTTP および HTTPS 応答に追加します。HTTP を HTTPS にリダイレクトするルートで insecureEdgeTerminationPolicy 値を使用できます。HSTS を強制している場合は、要求の送信前にクライアントがすべての要求を HTTP URL から HTTPS に変更するため、リダイレクトの必要がなくなります。

クラスター管理者は、以下を実行するために HSTS を設定できます。

- ルートごとに HSTS を有効にします。

- ルートごとに HSTS を無効にします。

- ドメインごとに HSTS を適用するか、ドメインと組み合わせた namespace ラベルを使用します。

HSTS はセキュアなルート (edge-terminated または re-encrypt) でのみ機能します。この設定は、HTTP または passthrough ルートには適していません。

1.2.1.1. ルートごとの HTTP Strict Transport Security の有効化

特定のアプリケーションに対して安全な HTTPS 接続を強制するには、ルートごとに HTTP Strict Transport Security (HSTS) を有効にします。haproxy.router.openshift.io/hsts_header アノテーションをエッジに適用してルートを再暗号化することで、ブラウザーが暗号化されていないトラフィックを拒否することが保証されます。

前提条件

- プロジェクトの管理者権限があるユーザーで、クラスターにログインしている。

-

OpenShift CLI (

oc) がインストールされている。

手順

ルートで HSTS を有効にするには、

haproxy.router.openshift.io/hsts_header値を edge-terminated または re-encrypt ルートに追加します。次のコマンドを実行すると、oc annotateツールを使用してこれを実行できます。コマンドを適切に実行するには、haproxy.router.openshift.io/hsts_header ルートアノテーション内のセミコロン (;) も二重引用符 ("") で囲まれていることを確認してください。最大経過時間を

31536000ミリ秒 (約 8.5 時間) に設定するアノテーションコマンドの例$ oc annotate route <route_name> -n <namespace> --overwrite=true "haproxy.router.openshift.io/hsts_header=max-age=31536000;\ includeSubDomains;preload"アノテーションで設定されたルートの例

apiVersion: route.openshift.io/v1 kind: Route metadata: annotations: haproxy.router.openshift.io/hsts_header: max-age=31536000;includeSubDomains;preload # ... spec: host: def.abc.com tls: termination: "reencrypt" ... wildcardPolicy: "Subdomain" # ...ここでは、以下のようになります。

max-age-

HSTS ポリシーの有効期間 (秒単位) を指定します。

0に設定すると、これはポリシーを無効にします。 サブドメインを含める- ホストのすべてのサブドメインは、ホストと同じ HSTS ポリシーを持つ必要があることを指定します。オプションのパラメーター。

プリロード-

max-ageが0より大きい場合に、サイトが HSTS プリロードリストに含まれることを指定します。たとえば、Google などのサイトはpreloadが設定されているサイトの一覧を作成します。ブラウザーはこれらのリストを使用し、サイトと対話する前でも HTTPS 経由で通信できるサイトを判別できます。preloadを設定していない場合、ブラウザーはヘッダーを取得するために、HTTPS を介してサイトと少なくとも 1 回対話している必要があります。オプションのパラメーター。

1.2.1.2. ルートごとの HTTP Strict Transport Security の無効化

暗号化されていない接続を許可したり、アクセスに関する問題をトラブルシューティングしたりするには、特定のルートに対して HTTP Strict Transport Security (HSTS) を無効にします。max-age ルートアノテーションを 0 に設定すると、ブラウザーはルートホスト上で HTTPS 要件の適用を停止します。

前提条件

- プロジェクトの管理者権限があるユーザーで、クラスターにログインしている。

-

OpenShift CLI (

oc) がインストールされている。

手順

HSTS を無効にするには、ルートアノテーションの

max-age値を0に設定するために、次のように入力します。$ oc annotate route <route_name> -n <namespace> --overwrite=true "haproxy.router.openshift.io/hsts_header"="max-age=0"ヒント代わりに、以下の YAML を適用して、ルートごとに HSTS を無効にするための config map を作成することもできます。

kind: Route apiVersion: route.openshift.io/v1 metadata: annotations: haproxy.router.openshift.io/hsts_header: max-age=0namespace のすべてのルートで HSTS を無効にするには、following コマンドを入力します。

$ oc annotate route --all -n <namespace> --overwrite=true "haproxy.router.openshift.io/hsts_header"="max-age=0"

検証

すべてのルートのアノテーションをクエリーするには、以下のコマンドを入力します。

$ oc get route --all-namespaces -o go-template='{{range .items}}{{if .metadata.annotations}}{{$a := index .metadata.annotations "haproxy.router.openshift.io/hsts_header"}}{{$n := .metadata.name}}{{with $a}}Name: {{$n}} HSTS: {{$a}}{{"\n"}}{{else}}{{""}}{{end}}{{end}}{{end}}'出力例

Name: routename HSTS: max-age=0

1.2.1.3. ドメインごとの HTTP Strict Transport Security の適用

セキュアなルートに対してドメインごとに HTTP Strict Transport Security (HSTS) を適用するには、Ingress 仕様に requiredHSTSPolicies レコードを追加して、HSTS ポリシーの設定を取得します。

requiredHSTSPolicy を設定して HSTS を適用する場合は、新規に作成されたルートは準拠された HSTS ポリシーアノテーションで設定する必要があります。

準拠しない HSTS ルートを持つアップグレードされたクラスターを処理するには、ソースでマニフェストを更新し、更新を適用できます。

oc expose route コマンドまたは oc create route コマンドを使用して、HSTS を強制するドメインにルートを追加することはできません。このコマンドの API はアノテーションを受け入れないためです。

HSTS がすべてのルートに対してグローバルに要求されている場合でも、セキュアではないルートや非 TLS ルートに適用することはできません。

前提条件

- プロジェクトの管理者権限があるユーザーで、クラスターにログインしている。

-

OpenShift CLI (

oc) がインストールされている。

手順

次のコマンドを実行し、必要に応じてフィールドを更新して、Ingress 設定 YAML を編集します。

$ oc edit ingresses.config.openshift.io/clusterHSTS ポリシーの例

apiVersion: config.openshift.io/v1 kind: Ingress metadata: name: cluster spec: domain: 'hello-openshift-default.apps.username.devcluster.openshift.com' requiredHSTSPolicies:1 - domainPatterns:2 - '*hello-openshift-default.apps.username.devcluster.openshift.com' - '*hello-openshift-default2.apps.username.devcluster.openshift.com' namespaceSelector:3 matchLabels: myPolicy: strict maxAge:4 smallestMaxAge: 1 largestMaxAge: 31536000 preloadPolicy: RequirePreload5 includeSubDomainsPolicy: RequireIncludeSubDomains6 - domainPatterns: - 'abc.example.com' - '*xyz.example.com' namespaceSelector: matchLabels: {} maxAge: {} preloadPolicy: NoOpinion includeSubDomainsPolicy: RequireNoIncludeSubDomains- 1

- 必須。

requiredHSTSPoliciesは順番に検証され、最初に一致するdomainPatternsが適用されます。 - 2

- 必須。1 つ以上の

domainPatternsホスト名を指定する必要があります。任意の数のドメインをリスト表示できます。さまざまなdomainPatternsについて、Enforcing オプションの複数のセクションを含めることができます。 - 3

- オプション:

namespaceSelectorを含める場合、ルートを配置するプロジェクトのラベルと一致する必要があります。これにより、ルートに設定された HSTS ポリシーを適用する必要があります。domainPatternsではなくnamespaceSelectorのみに一致するルートは検証されません。 - 4

- 必須。

max-ageは、HSTS ポリシーが有効な期間 (秒単位) を測定します。このポリシー設定により、最小および最大のmax-ageを適用することができます。-

largestMaxAgeの値は0から2147483647の範囲内で指定する必要があります。これを指定しないと、上限が強制されないことを意味します。 -

smallestMaxAgeの値は0から2147483647の範囲内で指定する必要があります。トラブルシューティングのために HSTS を無効にするには、0を入力します。HSTS を無効にする必要がない場合は1を入力します。これを指定しないと、下限が強制されません。

-

- 5

- オプション:

haproxy.router.openshift.io/hsts_headerにpreloadを含めることで、外部サービスがこのサイトをそれぞれの HSTS プリロードリストに含めることができます。ブラウザーはこれらの一覧を使用し、サイトと対話する前でも HTTPS 経由で通信できるサイトを判別できます。preload設定がない場合、ブラウザーは少なくともサイトと通信してヘッダーを取得する必要があります。preloadは、以下のいずれかで設定できます。-

RequirePreload:preloadはRequiredHSTSPolicyで必要になります。 -

RequireNoPreload:preloadはRequiredHSTSPolicyによって禁止されます。 -

NoOpinion:preloadはRequiredHSTSPolicyに重要ではありません。

-

- 6

- オプション:

includeSubDomainsPolicyは、以下のいずれかで設定できます。-

RequireIncludeSubDomains:includeSubDomainsはRequiredHSTSPolicyで必要です。 -

RequireNoIncludeSubDomains:includeSubDomainsはRequiredHSTSPolicyによって禁止されています。 -

NoOpinion:includeSubDomainsはRequiredHSTSPolicyに重要ではありません。

-

oc annotate commandを入力して、HSTS をクラスターのすべてのルートまたは特定の namespace に適用することができます。HSTS をクラスターのすべてのルートに適用するには、

oc annotate commandを実行します。以下に例を示します。$ oc annotate route --all --all-namespaces --overwrite=true "haproxy.router.openshift.io/hsts_header"="max-age=31536000"特定の namespace のすべてのルートに HSTS を適用するには、

oc annotate commandを実行します。以下に例を示します。$ oc annotate route --all -n my-namespace --overwrite=true "haproxy.router.openshift.io/hsts_header"="max-age=31536000"

検証

設定した HSTS ポリシーを確認できます。以下に例を示します。

必要な HSTS ポリシーの

maxAgeセットを確認するには、以下のコマンドを入力します。$ oc get clusteroperator/ingress -n openshift-ingress-operator -o jsonpath='{range .spec.requiredHSTSPolicies[*]}{.spec.requiredHSTSPolicies.maxAgePolicy.largestMaxAge}{"\n"}{end}'すべてのルートで HSTS アノテーションを確認するには、以下のコマンドを入力します。

$ oc get route --all-namespaces -o go-template='{{range .items}}{{if .metadata.annotations}}{{$a := index .metadata.annotations "haproxy.router.openshift.io/hsts_header"}}{{$n := .metadata.name}}{{with $a}}Name: {{$n}} HSTS: {{$a}}{{"\n"}}{{else}}{{""}}{{end}}{{end}}{{end}}'出力例

Name: <_routename_> HSTS: max-age=31536000;preload;includeSubDomains

1.3. ルートの設定

特定のトラフィック動作に合わせてルート設定をカスタマイズするには、アノテーション、ヘッダー、および Cookie を適用します。これらの仕組みを利用することで、きめ細かなルーティングルールを定義し、標準機能を拡張して複雑なアプリケーション要件に対応できます。

1.3.1. ルートのタイムアウトの設定

Service Level Availability (SLA) で必要とされる、低タイムアウトが必要なサービスや、バックエンドでの処理速度が遅いケースで高タイムアウトが必要なサービスがある場合は、既存のルートに対してデフォルトのタイムアウトを設定することができます。

OpenShift Container Platform クラスターの前にユーザー管理の外部ロードバランサーを設定した場合は、ユーザー管理の外部ロードバランサーのタイムアウト値がルートのタイムアウト値よりも高いことを確認してください。この設定により、クラスターが使用するネットワーク上でのネットワーク輻輳の問題を防ぐことができます。

前提条件

- 稼働中のクラスターに Ingress コントローラーをデプロイしました。

手順

oc annotateコマンドを使用して、ルートにタイムアウトを追加します。$ oc annotate route <route_name> \ --overwrite haproxy.router.openshift.io/timeout=<timeout><time_unit>< タイムアウト >: サポートされている時間単位は、マイクロ秒 (us)、ミリ秒 (ms)、秒 (s)、分 (m)、時間 (h)、または日 (d) です。以下の例では、2 秒のタイムアウトを

myrouteという名前のルートに設定します。$ oc annotate route myroute --overwrite haproxy.router.openshift.io/timeout=2s

1.3.2. HTTP ヘッダーの設定

アプリケーションのリクエストヘッダーとレスポンスヘッダーをカスタマイズするには、Ingress Controller を設定するか、特定のルートアノテーションを適用します。これらの設定方法間の相互作用を理解することで、グローバルヘッダーポリシーとルート固有のヘッダーポリシーを効果的に管理できます。

ルートアノテーションを使用して特定のヘッダーを設定することもできます。ヘッダーを設定するさまざまな方法は、連携時に課題となる可能性があります。

IngressController または Route CR 内のヘッダーは設定または削除のみ可能で、追加はできません。HTTP ヘッダーに値が設定されている場合、その値は完全である必要があるため、今後追加する必要はありません。X-Forwarded-For ヘッダーなどのヘッダーを追加することが適切な状況では、spec.httpHeaders.actions の代わりに spec.httpHeaders.forwardedHeaderPolicy フィールドを使用します。

- 優先順位

同じ HTTP ヘッダーを Ingress Controller とルートの両方で変更すると、HAProxy は、それがリクエストヘッダーであるか応答ヘッダーであるかに応じて、特定の方法でアクションの優先順位を付けます。

- HTTP 応答ヘッダーの場合、Ingress Controller で指定されたアクションは、ルートで指定されたアクションの後に実行されます。これは、Ingress Controller で指定されたアクションが優先されることを意味します。

- HTTP リクエストヘッダーの場合、ルートで指定されたアクションは、Ingress Controller で指定されたアクションの後に実行されます。これは、ルートで指定されたアクションが優先されることを意味します。

たとえば、クラスター管理者は、次の設定を使用して、Ingress Controller で X-Frame-Options 応答ヘッダーに値 DENY を設定します。

IngressController 仕様の例

apiVersion: operator.openshift.io/v1

kind: IngressController

# ...

spec:

httpHeaders:

actions:

response:

- name: X-Frame-Options

action:

type: Set

set:

value: DENY

ルート所有者は、クラスター管理者が Ingress Controller に設定したものと同じ応答ヘッダーを設定しますが、次の設定を使用して値 SAMEORIGIN を設定します。

Route 仕様の例

apiVersion: route.openshift.io/v1

kind: Route

# ...

spec:

httpHeaders:

actions:

response:

- name: X-Frame-Options

action:

type: Set

set:

value: SAMEORIGIN

IngressController 仕様と Route 仕様の両方で X-Frame-Options 応答ヘッダーが設定されている場合、特定のルートでフレームが許可されている場合でも、Ingress Controller のグローバルレベルでこのヘッダーに設定された値が優先されます。リクエストヘッダーの場合、Route 仕様の値が IngressController 仕様の値をオーバーライドします。

この優先順位付けは、haproxy.config ファイルで次のロジックが使用されるため発生します。このロジックでは、Ingress Controller がフロントエンドと見なされ、個々のルートがバックエンドと見なされます。フロントエンド設定に適用されるヘッダー値 DENY は、バックエンドで設定されている値 SAMEORIGIN で同じヘッダーをオーバーライドします。

frontend public

http-response set-header X-Frame-Options 'DENY'

frontend fe_sni

http-response set-header X-Frame-Options 'DENY'

frontend fe_no_sni

http-response set-header X-Frame-Options 'DENY'

backend be_secure:openshift-monitoring:alertmanager-main

http-response set-header X-Frame-Options 'SAMEORIGIN'さらに、Ingress Controller またはルートのいずれかで定義されたアクションは、ルートアノテーションを使用して設定された値をオーバーライドします。

- 特殊なケースのヘッダー

- 次のヘッダーは、設定または削除が完全に禁止されているか、特定の状況下で許可されています。

| ヘッダー名 | IngressController 仕様を使用して設定可能かどうか | Route 仕様を使用して設定可能かどうか | 不許可の理由 | 別の方法で設定可能かどうか |

|---|---|---|---|---|

|

| いいえ | いいえ |

| いいえ |

|

| いいえ | はい |

| いいえ |

|

| いいえ | いいえ |

|

はい: |

|

| いいえ | いいえ | HAProxy が設定する Cookie は、クライアント接続を特定のバックエンドサーバーにマップするセッション追跡に使用されます。これらのヘッダーの設定を許可すると、HAProxy のセッションアフィニティーが妨げられ、HAProxy の Cookie の所有権が制限される可能性があります。 | はい:

|

1.3.3. ルート内の HTTP リクエストおよびレスポンスヘッダーの設定または削除

コンプライアンス目的またはその他の理由で、特定の HTTP 要求および応答ヘッダーを設定または削除できます。これらのヘッダーは、Ingress Controller によって提供されるすべてのルート、または特定のルートに対して設定または削除できます。

たとえば、ルートを提供する Ingress Controller によってデフォルトのグローバルな場所が指定されている場合でも、コンテンツが複数の言語で記述されていると、Web アプリケーションが特定のルートの別の場所でコンテンツを提供するように指定できます。

以下の手順では Content-Location HTTP リクエストヘッダーを設定するルートを作成し、アプリケーション (https://app.example.com) に URL が関連付けられ、https://app.example.com/lang/en-us のロケーションにダイレクトされるようにします。アプリケーショントラフィックをこの場所にダイレクトすると、特定のルートを使用する場合はすべて、アメリカ英語で記載された Web コンテンツにアクセスすることになります。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 - プロジェクト管理者として OpenShift Container Platform クラスターにログインしている。

- ポートを公開する Web アプリケーションと、そのポート上のトラフィックをリッスンする HTTP または TLS エンドポイントがある。

手順

ルート定義を作成し、

app-example-route.yamlというファイルに保存します。HTTP ヘッダーディレクティブを使用して作成されたルートの YAML 定義

apiVersion: route.openshift.io/v1 kind: Route # ... spec: host: app.example.com tls: termination: edge to: kind: Service name: app-example httpHeaders: actions: response: - name: Content-Location action: type: Set set: value: /lang/en-us # ...ここでは、以下のようになります。

actions- HTTP ヘッダーに対して実行するアクションのリストを指定します。

response- 変更したいヘッダーの種類を指定します。この場合は、応答ヘッダーです。

レスポンス名- 変更したいヘッダーの名前を指定します。設定または削除できる使用可能なヘッダーのリストは、HTTP ヘッダーの設定 を参照してください。

アクション.タイプ-

ヘッダーに対して実行されるアクションの種類を指定します。このフィールドには、

SetまたはDeleteの値を指定できます。 設定値-

HTTP ヘッダーの設定時は、

値を指定する必要があります。値は、そのヘッダーで使用可能なディレクティブのリストからの文字列 (例:DENY)にすることも、HAProxy の動的値構文を使用して解釈される動的値にすることもできます。この場合、値はコンテンツの相対位置に設定されます。

新しく作成したルート定義を使用して、既存の Web アプリケーションへのルートを作成します。

$ oc -n app-example create -f app-example-route.yamlHTTP リクエストヘッダーの場合、ルート定義で指定されたアクションは、Ingress Controller の HTTP リクエストヘッダーに対して実行されたアクションの後に実行されます。これは、ルート内のこれらのリクエストヘッダーに設定された値が、Ingress Controller に設定された値よりも優先されることを意味します。HTTP ヘッダーの処理順序の詳細は、HTTP ヘッダーの設定 を参照してください。

1.3.4. Cookie の使用によるルートのステートフル性の維持

Pod の再起動やスケーリングイベント中にステートフルなアプリケーショントラフィックを維持するには、Cookie を使用してスティッキーセッションを設定します。この方法を用いることで、すべての受信トラフィックが同じエンドポイントに到達することが保証され、特定のエンドポイント Pod が変更された場合でも状態の損失を防ぐことができます。

OpenShift Container Platform は Cookie を使用してセッションの永続化を設定できます。Ingress コントローラーは、ユーザーからのリクエストを処理するエンドポイントを選択し、セッション用の Cookie を作成します。Cookie は要求の応答として戻され、ユーザーは Cookie をセッションの次の要求と共に送り返します。Cookie は Ingress Controller に対し、セッションを処理しているエンドポイントを示し、クライアント要求が Cookie を使用して同じ Pod にルーティングされるようにします。

Cookie は、HTTP トラフィックを表示できないので、passthrough ルートで設定できません。代わりに、送信元 IP アドレスをベースに数が計算され、バックエンドを判断します。

バックエンドが変わると、トラフィックが間違ったサーバーに転送されてしまい、スティッキーではなくなります。送信元 IP を非表示にするロードバランサーを使用している場合は、すべての接続に同じ番号が設定され、トラフィックは同じ Pod に送られます。

1.3.4.1. Cookie を使用したルートのアノテーション

アプリケーションがセッションの永続性と負荷分散を管理できるようにするには、ルートにカスタムの Cookie 名をアノテーションとして追加します。デフォルトの Cookie を上書きすることで、バックエンドアプリケーションは特定の Cookie を識別して削除できるようになり、必要に応じてエンドポイントの再選択を強制できます。

サーバーが過負荷状態になると、サーバーはクライアントからのリクエストを削除し、他のエンドポイントにリクエストを再分配しようとします。

手順

指定される cookie 名でルートにアノテーションを付けます。

$ oc annotate route <route_name> router.openshift.io/cookie_name="<cookie_name>"ここでは、以下のようになります。

<route_name>- ルートの名前を指定します。

<cookie_name>cookie の名前を指定します。

たとえば、ルート

my_routeに cookie 名my_cookieでアノテーションを付けるには、以下を実行します。$ oc annotate route my_route router.openshift.io/cookie_name="my_cookie"

変数でルートのホスト名を取得します。

$ ROUTE_NAME=$(oc get route <route_name> -o jsonpath='{.spec.host}')ここでは、以下のようになります。

<route_name>- ルートの名前を指定します。

cookie を保存してからルートにアクセスします。

$ curl $ROUTE_NAME -k -c /tmp/cookie_jarルートに接続する際に、直前のコマンドによって保存される cookie を使用します。

$ curl $ROUTE_NAME -k -b /tmp/cookie_jar

1.3.5. ルート固有のアノテーション

Ingress Controller は、公開するすべてのルートのデフォルトオプションを設定できます。個別のルートは、アノテーションに個別の設定を指定して、デフォルトの一部を上書きできます。Red Hat では、ルートアノテーションの Operator 管理ルートへの追加はサポートしません。

複数の送信元 IP またはサブネットを含む許可リストを作成するには、スペースで区切られたリストを使用します。他の区切りタイプを使用すると、リストが警告やエラーメッセージなしに無視されます。

| 変数 | 説明 |

|---|---|

|

|

ロードバランシングアルゴリズムを設定します。使用できるオプションは、 |

|

|

関連の接続を追跡する cookie の使用を無効にします。 |

|

| このルートに使用するオプションの cookie を指定します。名前は、大文字、小文字、数字、"_" または "-" を任意に組み合わせて指定する必要があります。デフォルトは、ルートのハッシュ化された内部キー名です。 |

|

|

ルーターからバッキングされる Pod に対して許容される接続最大数を設定します。 |

|

|

|

|

|

同じ送信元 IP アドレスで行われる同時 TCP 接続の数を制限します。数値を受け入れます。 |

|

|

同じ送信元 IP アドレスを持つクライアントが HTTP 要求を実行できるレートを制限します。数値を受け入れます。 |

|

|

同じ送信元 IP アドレスを持つクライアントが TCP 接続を確立するレートを制限します。数値を受け入れます。 |

|

| バックエンドのヘルスチェックの間隔を設定します。(TimeUnits) |

|

| ルートの許可リストを設定します。許可リストは、承認したソースアドレスの IP アドレスおよび CIDR 範囲のリストをスペース区切りにしたリストです。許可リストに含まれていない IP アドレスからの要求は破棄されます。

|

|

| edge terminated または re-encrypt ルートの Strict-Transport-Security ヘッダーを設定します。 |

|

| バックエンドの要求の書き換えパスを設定します。 |

|

| Cookie を制限するために値を設定します。値は以下のようになります。

この値は、re-encrypt および edge ルートにのみ適用されます。詳細は、SameSite cookie のドキュメント を参照してください。 |

|

|

ルートごとに

|

-

デフォルトでは、ルーターは 5 秒ごとにリロードされ、最初から Pod 間の接続のバランスがリセットされます。その結果、

roundrobin状態はリロード間で保持されません。このアルゴリズムは、Pod のコンピューティング能力とストレージ容量がほぼ同じである場合に最適に機能します。たとえば、CI/CD パイプラインの使用により、アプリケーションまたはサービスのエンドポイントが継続的に変更される場合、結果的にバランスが不均一になる可能性があります。その場合は別のアルゴリズムを使用します。 許可リストの IP アドレスと CIDR 範囲の数が 61 を超えると、それらは別のファイルに書き込まれます。これは

haproxy.configファイルから参照されます。このファイルは、/var/lib/haproxy/router/allowlistsフォルダーに保存されます。注記アドレスが許可リストに書き込まれることを確認するには、CIDR 範囲の完全なリストが Ingress Controller 設定ファイルに記載されていることを確認します。etcd オブジェクトサイズ制限は、ルートアノテーションのサイズを制限します。このため、許可リストに追加できる IP アドレスと CIDR 範囲の最大数のしきい値が作成されます。

特定の IP アドレスを 1 つだけ許可するルート

metadata:

annotations:

haproxy.router.openshift.io/ip_allowlist: 192.168.1.10ロードバランシングアルゴリズムを leastconn に設定するルート

metadata:

annotations:

haproxy.router.openshift.io/balance: leastconn-

デフォルトの負荷分散アルゴリズムは

ランダムです。

複数の IP アドレスを許可するルート

metadata:

annotations:

haproxy.router.openshift.io/ip_allowlist: 192.168.1.10 192.168.1.11 192.168.1.12IP アドレスの CIDR ネットワークを許可するルート

metadata:

annotations:

haproxy.router.openshift.io/ip_allowlist: 192.168.1.0/24IP アドレスと IP アドレスの CIDR ネットワークの両方を許可するルート

metadata:

annotations:

haproxy.router.openshift.io/ip_allowlist: 180.5.61.153 192.168.1.0/24 10.0.0.0/8書き換えターゲットを指定するルート

apiVersion: route.openshift.io/v1

kind: Route

metadata:

annotations:

haproxy.router.openshift.io/rewrite-target: /

...- 1

- バックエンドの要求の書き換えパスとして

/を設定します。

ルートに haproxy.router.openshift.io/rewrite-target アノテーションを設定すると、要求をバックエンドアプリケーションに転送する前に Ingress Controller がこのルートを使用して HTTP 要求のパスを書き換える必要があることを指定します。spec.path で指定されたパスに一致する要求パスの一部は、アノテーションで指定された書き換えターゲットに置き換えられます。

以下の表は、spec.path、要求パス、および書き換えターゲットの各種の組み合わせに関するパスの書き換え動作の例を示しています。

| Route.spec.path | 要求パス | 書き換えターゲット | 転送された要求パス |

|---|---|---|---|

| /foo | /foo | / | / |

| /foo | /foo/ | / | / |

| /foo | /foo/bar | / | /bar |

| /foo | /foo/bar/ | / | /bar/ |

| /foo | /foo | /bar | /bar |

| /foo | /foo/ | /bar | /bar/ |

| /foo | /foo/bar | /baz | /baz/bar |

| /foo | /foo/bar/ | /baz | /baz/bar/ |

| /foo/ | /foo | / | 該当なし (要求パスがルートパスに一致しない) |

| /foo/ | /foo/ | / | / |

| /foo/ | /foo/bar | / | /bar |

haproxy.router.openshift.io/rewrite-target 内の特定の特殊文字は、適切にエスケープする必要があるため、特別な処理が必要です。これらの文字がどのように処理されるかは、次の表を参照してください。

| 以下の文字の場合 | 以下の文字を使用 | 注記 |

|---|---|---|

| # | \# | # は書き換え式を終了させるので使用しないでください。 |

| % | % または %% | %%% のような変則的なシーケンスは避けてください。 |

| ‘ | \’ | ‘ は無視されるので避けてください。 |

その他の有効な URL 文字はすべてエスケープせずに使用できます。

1.3.6. スループットの問題のトラブルシューティング方法

特定のサービス間のレイテンシーが異常に高いなど、ネットワークスループットの問題を診断および解決するには、トラブルシューティング手法を適用します。接続のボトルネックを特定することで、OpenShift Container Platform 内でのアプリケーションの安定したパフォーマンスを確保できます。

Pod のログが問題の原因を指摘しない場合は、以下の方法を使用してパフォーマンスの問題を分析します。

pingまたはtcpdumpなどのパケットアナライザーを使用して Pod とそのノード間のトラフィックを分析します。たとえば、問題を生じさせる動作を再現している間に各ノードで

tcpdumpツールを実行 します。両サイトでキャプチャーしたデータを確認し、送信および受信タイムスタンプを比較して Pod への/からのトラフィックの待ち時間を分析します。待ち時間は、ノードのインターフェイスが他の Pod やストレージデバイス、またはデータプレーンからのトラフィックでオーバーロードする場合に OpenShift Container Platform で発生する可能性があります。$ tcpdump -s 0 -i any -w /tmp/dump.pcap host <podip 1> && host <podip 2>1 ここでは、以下のようになります。

ポディップPod の IP アドレスを指定します。

oc get pod <pod_name> -o wideコマンドを実行して Pod の IP アドレスを取得します。tcpdumpは、これらの 2 つの Pod 間のすべてのトラフィックが含まれる/tmp/dump.pcapのファイルを生成します。ファイルサイズを最小限に抑えるために問題を再現するすぐ前と問題を再現したすぐ後ににアナライザーを実行することが良いでしょう。次のコマンドを使用して、ノード間でパケットアナライザーを実行 することもできます。$ tcpdump -s 0 -i any -w /tmp/dump.pcap port 4789

ストリーミングのスループットおよび UDP スループットを測定するために

iperfなどの帯域幅測定ツールを使用します。最初に Pod からツールを実行し、次にノードから実行して、ボトルネックを特定します。-

iperfのインストールおよび使用に関する詳細は、こちらの Red Hat ソリューション を参照してください。

-

- 場合によっては、レイテンシーの問題が原因で、クラスターがルーター Pod を含むノードを異常としてマークすることがあります。ワーカーレイテンシープロファイルを使用して、アクションを実行する前にクラスターがノードからステータスの最新情報を受け取る頻度を調節します。

-

クラスターでレイテンシーの低いノードとレイテンシーの高いノードが指定されている場合は、Ingress Controller の

spec.nodePlacementフィールドを設定して、ルーター Pod の配置を制御します。

1.3.7. ルートの受付ポリシーの設定

管理者およびアプリケーション開発者は、同じドメイン名を持つ複数の namespace でアプリケーションを実行できます。これは、複数のチームが同じホスト名で公開されるマイクロサービスを開発する組織を対象としています。

複数の namespace での要求の許可は、namespace 間の信頼のあるクラスターに対してのみ有効にする必要があります。有効にしないと、悪意のあるユーザーがホスト名を乗っ取る可能性があります。このため、デフォルトの受付ポリシーは複数の namespace 間でのホスト名の要求を許可しません。

前提条件

- クラスター管理者の権限。

手順

以下のコマンドを使用して、

ingresscontrollerリソース変数の.spec.routeAdmissionフィールドを編集します。$ oc -n openshift-ingress-operator patch ingresscontroller/default --patch '{"spec":{"routeAdmission":{"namespaceOwnership":"InterNamespaceAllowed"}}}' --type=mergeイメージコントローラー設定例

spec: routeAdmission: namespaceOwnership: InterNamespaceAllowed ...ヒントまたは、以下の YAML を適用してルートの受付ポリシーを設定できます。

apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: routeAdmission: namespaceOwnership: InterNamespaceAllowed

1.3.8. デュアルスタックネットワーク用の OpenShift Container Platform Ingress Controller の設定

OpenShift Container Platform クラスターが IPv4 および IPv6 デュアルスタックネットワーク用に設定されている場合、クラスターは OpenShift Container Platform ルートによって外部からアクセス可能です。

Ingress Controller は、IPv4 エンドポイントと IPv6 エンドポイントの両方を持つサービスを自動的に提供しますが、シングルスタックまたはデュアルスタックサービス用に Ingress Controller を設定できます。

前提条件

- ベアメタルに OpenShift Container Platform クラスターをデプロイしていること。

-

OpenShift CLI (

oc) がインストールされている。

手順

Ingress Controller が、IPv4 / IPv6 を介してトラフィックをワークロードに提供するようにするには、

ipFamiliesフィールドおよびipFamilyPolicyフィールドを設定して、サービス YAML ファイルを作成するか、既存のサービス YAML ファイルを変更します。以下に例を示します。サービス YAML ファイルの例

apiVersion: v1 kind: Service metadata: creationTimestamp: yyyy-mm-ddT00:00:00Z labels: name: <service_name> manager: kubectl-create operation: Update time: yyyy-mm-ddT00:00:00Z name: <service_name> namespace: <namespace_name> resourceVersion: "<resource_version_number>" selfLink: "/api/v1/namespaces/<namespace_name>/services/<service_name>" uid: <uid_number> spec: clusterIP: 172.30.0.0/16 clusterIPs:1 - 172.30.0.0/16 - <second_IP_address> ipFamilies:2 - IPv4 - IPv6 ipFamilyPolicy: RequireDualStack3 ports: - port: 8080 protocol: TCP targetport: 8080 selector: name: <namespace_name> sessionAffinity: None type: ClusterIP status: loadbalancer: {}endpointsを表示するには、以下のコマンドを入力します。$ oc get endpointsendpointslicesを表示するには、以下のコマンドを入力します。$ oc get endpointslices

1.4. 高度なルートの作成

アプリケーションのトラフィックを保護し、クライアントにカスタム証明書を提供するには、エッジ、パススルー、または再暗号化 TLS 終端を使用してルートを設定します。これらの方法を用いることで、きめ細かな暗号化ルールを定義し、特定のセキュリティー要件に従ってトラフィックが復号化および再暗号化されるようにすることができます。

1.4.1. カスタム証明書を使用した edge ルートの作成

カスタム証明書を使用してトラフィックを保護するには、oc create route コマンドを実行して、エッジ TLS 終端を含むルートを設定します。この設定では、Ingress Controller で暗号化を終了させてから、宛先 Pod にトラフィックを転送します。

ルートは、Ingress Controller がルートに使用する TLS 証明書およびキーを指定します。

この手順では、カスタム証明書とエッジ TLS 終端を備えた ルート リソースを作成します。この手順では、証明書と秘密鍵のペアが現在の作業ディレクトリー内の tls.crt ファイルと tls.key ファイルに格納されていることを前提としています。必要な場合には、証明書チェーンを完了するために CA 証明書を指定することもできます。tls.crt、tls.key、および (オプションで) ca.crt を実際のパス名に置き換えます。frontend を、公開する必要のあるサービスの名前に置き換えます。www.example.com を適切な名前に置き換えます。

前提条件

- PEM エンコードされたファイルに証明書/キーのペアが必要です。ここで、証明書はルートホストに対して有効となっています。

- 証明書チェーンを完成させるために、PEM エンコードされたファイル内に別の CA 証明書が存在する場合があります。

- 公開する必要のあるサービスが必要です。

パスワードで保護されるキーファイルはサポートされません。キーファイルからパスフレーズを削除するには、以下のコマンドを使用します。

$ openssl rsa -in password_protected_tls.key -out tls.key手順

edge TLS termination およびカスタム証明書を使用して、セキュアな

Routeリソースを作成します。$ oc create route edge --service=frontend --cert=tls.crt --key=tls.key --ca-cert=ca.crt --hostname=www.example.com生成された

Routeリソースを調べると、そのリソースには次の例のような設定が含まれているはずです。セキュアなルートの YAML 定義

apiVersion: route.openshift.io/v1 kind: Route metadata: name: frontend spec: host: www.example.com to: kind: Service name: frontend tls: termination: edge key: |- -----BEGIN PRIVATE KEY----- [...] -----END PRIVATE KEY----- certificate: |- -----BEGIN CERTIFICATE----- [...] -----END CERTIFICATE----- caCertificate: |- -----BEGIN CERTIFICATE----- [...] -----END CERTIFICATE----- # ...他のオプションは、

oc create route edge --helpを参照してください。

1.4.2. カスタム証明書を使用した re-encrypt ルートの作成

カスタム証明書を使用してトラフィックを保護するには、oc create route コマンドを実行して、TLS 終端を再暗号化するルートを設定します。この設定により、イングレスコントローラーはトラフィックを復号化し、宛先 Pod に転送する前にトラフィックを再暗号化することができます。

この手順では、カスタム証明書を使用して ルート リソースを作成し、TLS 終端を再暗号化します。この手順では、証明書と秘密鍵のペアが現在の作業ディレクトリー内の tls.crt ファイルと tls.key ファイルに格納されていることを前提としています。また、Ingress Controller がサービスの証明書を信頼できるように宛先 CA 証明書を指定する必要もあります。必要な場合には、証明書チェーンを完了するために CA 証明書を指定することもできます。tls.crt、tls.key、cacert.crt、および (オプションで) ca.crt を実際のパス名に置き換えます。frontend を、公開する必要のある Service リソースに置き換えます。www.example.com を適切な名前に置き換えます。

前提条件

- PEM エンコードされたファイルに証明書/キーのペアが必要です。ここで、証明書はルートホストに対して有効となっています。

- 証明書チェーンを完了する PEM エンコードされたファイルの別の CA 証明書が必要です。

- PEM エンコードされたファイルの別の宛先 CA 証明書が必要です。

- 公開する必要のあるサービスが必要です。

パスワードで保護されるキーファイルはサポートされません。キーファイルからパスフレーズを削除するには、以下のコマンドを使用します。

$ openssl rsa -in password_protected_tls.key -out tls.key手順

reencrypt TLS 終端およびカスタム証明書を使用してセキュアな

Routeリソースを作成します。$ oc create route reencrypt --service=frontend --cert=tls.crt --key=tls.key --dest-ca-cert=destca.crt --ca-cert=ca.crt --hostname=www.example.com生成された

Routeリソースを調べると、そのリソースには次の例のような設定が含まれているはずです。セキュアなルートの YAML 定義

apiVersion: route.openshift.io/v1 kind: Route metadata: name: frontend spec: host: www.example.com to: kind: Service name: frontend tls: termination: reencrypt key: |- -----BEGIN PRIVATE KEY----- [...] -----END PRIVATE KEY----- certificate: |- -----BEGIN CERTIFICATE----- [...] -----END CERTIFICATE----- caCertificate: |- -----BEGIN CERTIFICATE----- [...] -----END CERTIFICATE----- destinationCACertificate: |- -----BEGIN CERTIFICATE----- [...] -----END CERTIFICATE----- # ...他のオプションは、

oc create route reencrypt --helpを参照してください。

1.4.3. passthrough ルートの作成

ルーターで復号化せずに暗号化されたトラフィックを宛先に直接送信するには、oc create route コマンドを実行して、パススルー終端を含むルートを設定します。この設定では、宛先 Pod が TLS 終端を処理するため、ルート上にキーや証明書は必要ありません。

前提条件

- 公開する必要のあるサービスが必要です。

手順

Routeリソースを作成します。$ oc create route passthrough route-passthrough-secured --service=frontend --port=8080結果として生成される

Routeリソースを検査すると、以下のようになります。passthrough 終端を使用したセキュアなルート

apiVersion: route.openshift.io/v1 kind: Route metadata: name: route-passthrough-secured spec: host: www.example.com port: targetPort: 8080 tls: termination: passthrough insecureEdgeTerminationPolicy: None to: kind: Service name: frontendここでは、以下のようになります。

metadata.name- オブジェクトの名前を指定します。文字数は 63 文字までです。

tls.termination-

終端フィールドがパススルーに設定されていることを示します。これは、必要な唯一のtlsフィールドです。 tls.insecureEdgeTerminationPolicyエッジ終端ポリシーの種類を指定します。オプションのパラメーター。唯一有効な値は

None、Redirect、または空の値です (無効にする場合)。宛先 Pod は、エンドポイントでトラフィックに証明書を提供します。これは、必須となるクライアント証明書をサポートするための唯一の方法です (相互認証とも呼ばれる)。

1.4.4. Ingress アノテーションでの宛先 CA 証明書を使用したルート作成

カスタム宛先 CA 証明書を使用してルートを定義するには、Ingress オブジェクトに route.openshift.io/destination-ca-certificate-secret アノテーションを適用します。この設定により、イングレスコントローラーは指定されたシークレットを使用して、宛先サービスのアイデンティティーを検証することが保証されます。

前提条件

- 証明書と秘密鍵のペアが PEM エンコードされたファイルに格納されており、その証明書はルートホストに対して有効です。

- 証明書チェーンを完成させるための、PEM エンコードされたファイル形式の別の CA 証明書があります。

- 宛先 CA 証明書は、PEM エンコードされたファイルで別途用意されています。

- 公開したいサービスがあります。

手順

次のコマンドを入力して、宛先 CA 証明書のシークレットを作成します。

$ oc create secret generic dest-ca-cert --from-file=tls.crt=<file_path>以下に例を示します。

$ oc -n test-ns create secret generic dest-ca-cert --from-file=tls.crt=tls.crt出力例

secret/dest-ca-cert createdroute.openshift.io/destination-ca-certificate-secretを Ingress アノテーションに追加します。apiVersion: networking.k8s.io/v1 kind: Ingress metadata: name: frontend annotations: route.openshift.io/termination: "reencrypt" route.openshift.io/destination-ca-certificate-secret: secret-ca-cert ...ここでは、以下のようになります。

宛先 CA 証明書シークレットroute.openshift.io/destination-ca-certificate-secretアノテーションを指定します。このアノテーションは Kubernetes のシークレットを参照しています。Ingress コントローラーは、アノテーションで参照されているシークレットを生成されたルートに挿入します。

出力例

apiVersion: route.openshift.io/v1 kind: Route metadata: name: frontend annotations: route.openshift.io/termination: reencrypt route.openshift.io/destination-ca-certificate-secret: secret-ca-cert spec: ... tls: insecureEdgeTerminationPolicy: Redirect termination: reencrypt destinationCACertificate: | -----BEGIN CERTIFICATE----- [...] -----END CERTIFICATE----- ...

1.4.5. 外部管理証明書を使用したルートの作成

ルート API の .spec.tls.externalCertificate フィールドを使用して、サードパーティーの証明書管理ソリューションで OpenShift Container Platform ルートを設定できます。シークレットを介して外部で管理されている TLS 証明書を参照できるため、手動での証明書管理が不要になります。

外部で管理される証明書を使用することでエラーが減り、証明書の更新がよりスムーズにロールアウトされます。これにより、OpenShift ルーターは更新された証明書を迅速に提供できます。外部で管理された証明書は、edge ルートと re-encrypt ルートの両方で使用できます。

前提条件

-

tls.keyキーとtls.crtキーの両方を含む、kubernetes.io/tlsタイプの PEM エンコード形式の有効な証明書またはキーペアを含むシークレットが必要です。サンプルコマンド:$ oc create secret tls myapp-tls --cert=server.crt --key=server.key。

手順

次のコマンドを実行して、シークレットと同じ namespace に

roleオブジェクトを作成し、ルーターサービスアカウントに読み取りアクセスを許可します。$ oc create role secret-reader --verb=get,list,watch --resource=secrets --resource-name=<secret-name> \ --namespace=<current-namespace>-

<secret-name>: シークレットの実際の名前を指定します。 -

<current-namespace>: シークレットとルートの両方が存在する namespace を指定します。

-

次のコマンドを実行して、シークレットと同じ namespace に

rolebindingオブジェクトを作成し、ルーターサービスアカウントを新しく作成されたロールにバインドします。$ oc create rolebinding secret-reader-binding --role=secret-reader --serviceaccount=openshift-ingress:router --namespace=<current-namespace>-

<current-namespace>: シークレットとルートの両方が存在する namespace を指定します。

-

次の例を使用して、

routeを定義し、証明書を含むシークレットを指定する YAML ファイルを作成します。セキュアなルートの YAML 定義

apiVersion: route.openshift.io/v1 kind: Route metadata: name: myedge namespace: test spec: host: myedge-test.apps.example.com tls: externalCertificate: name: <secret-name> termination: edge [...] [...]-

<secret-name>: シークレットの実際の名前を指定します。

-

次のコマンドを実行して

routeリソースを作成します。$ oc apply -f <route.yaml><route.yaml>: 生成された YAML ファイル名を指定します。シークレットが存在し、証明書/キーペアがある場合、すべての前提条件が満たされていれば、ルーターは生成された証明書を提供します。

注記.spec.tls.externalCertificateが指定されていないと、ルーターはデフォルトで生成された証明書を使用します。.spec.tls.externalCertificateフィールドを使用する場合は、.spec.tls.certificateフィールドまたは.spec.tls.keyフィールドを指定することはできません。

1.4.6. Ingress オブジェクトを介してデフォルトの証明書を使用してルートを作成する

デフォルトのイングレス証明書を使用する、安全なエッジ終端ルートを生成するには、Ingress オブジェクトに空の TLS 設定を指定します。この設定はデフォルトの動作を上書きし、安全でないルートの作成を防ぎます。

前提条件

- 公開したいサービスがあります。

-

OpenShift CLI (

oc) にアクセスできる。

手順

Ingress オブジェクトの YAML ファイルを作成します。次の例では、ファイル名は

example-ingress.yamlです。Ingress オブジェクトの YAML 定義

apiVersion: networking.k8s.io/v1 kind: Ingress metadata: name: frontend ... spec: rules: ... tls: - {}ここでは、以下のようになります。

spec.tls- TLS 設定を指定します。カスタム証明書を指定せずに TLS を指定するには、示されている構文を正確に使用してください。

次のコマンドを実行して、Ingress オブジェクトを作成します。

$ oc create -f example-ingress.yaml

検証

以下のコマンドを実行して、OpenShift Container Platform が Ingress オブジェクトの予期されるルートを作成したことを確認します。

$ oc get routes -o yaml出力例

apiVersion: v1 items: - apiVersion: route.openshift.io/v1 kind: Route metadata: name: frontend-j9sdd # ... spec: ... tls: insecureEdgeTerminationPolicy: Redirect termination: edge # ...ここでは、以下のようになります。

metadata.name- ルート名を指定します。ルート名には、Ingress オブジェクトの名前の後にランダムな接尾辞が付加されます。

spec.tls-

デフォルトの証明書を使用するには、ルートで

spec.certificateを指定してはいけません。 tls.termination-

ルートの終了ポリシーを指定します。ルートは、

edgeの終了ポリシーを指定する必要があります。

第2章 Ingress クラスタートラフィックの設定

2.1. Ingress クラスタートラフィックの設定の概要

OpenShift Container Platform 内の外部ネットワークとサービス間の通信を有効にするには、Ingress クラスタートラフィックを設定します。

2.1.1. クラスター外部からの通信方法

OpenShift Container Platform 内の外部ネットワークとサービス間の通信を有効にするには、適切なイングレス方式を設定します。

OpenShift Container Platform は、クラスター内で実行されるサービスを使用してクラスター外からの通信を可能にする以下の方法を提供します。なお、これらの方法は優先順位の高い順に記載されています。

- HTTP/HTTPS を使用する場合は Ingress Controller を使用する。

- HTTPS 以外の TLS で暗号化されたプロトコルを使用する場合、たとえば、SNI ヘッダーを使用する TLS の場合は、Ingress Controller を使用します。

-

それ以外の場合は、ロードバランサー、外部 IP、または

NodePortを使用します。

| 方法 | 目的 |

|---|---|

| Ingress Controller の使用 | HTTP/HTTPS トラフィックおよび HTTPS 以外の TLS で暗号化されたプロトコル (TLS と SNI ヘッダーの使用など) へのアクセスを許可します。 |

| ロードバランサーサービスを使用した外部 IP の自動割り当て | プールから割り当てられた IP アドレスを使用した非標準ポートへのトラフィックを許可します。ほとんどのクラウドプラットフォームは、ロードバランサーの IP アドレスでサービスを開始する方法を提供します。 |

| MetalLB および MetalLB Operator について | マシンネットワーク上のプールから特定の IP アドレスまたはアドレスへのトラフィックを許可します。ベアメタルインストールまたはベアメタルのようなプラットフォームの場合、MetalLB は、ロードバランサーの IP アドレスを使用してサービスを開始する方法を提供します。 |

| 外部 IP のサービスへの手動割り当て | 特定の IP アドレスを使用した非標準ポートへのトラフィックを許可します。 |

|

| クラスターのすべてのノードでサービスを公開します。 |

2.1.3. 比較: 外部 IP アドレスへのフォールトトレラントアクセス

OpenShift Container Platform において、サービスの継続的な可用性を確保し、外部 IP アクセスを維持するために、耐障害性のあるネットワーク機能を設定してください。

外部 IP アドレスへのアクセスを提供する通信メソッドの場合、IP アドレスへのフォールトトレランスアクセスは別の考慮事項となります。以下の機能は、外部 IP アドレスへのフォールトトレランスアクセスを提供します。

- IP フェイルオーバー

- IP フェイルオーバーは、一連のノードに対して仮想 IP アドレスのプールを管理します。IP フェイルオーバーは、Keepalived と Virtual Router Redundancy Protocol (VRRP) によって実装されます。IP フェイルオーバーはレイヤー 2 のメカニズムのみで、マルチキャストに依存します。マルチキャストには、一部のネットワークに欠点がある場合があります。

- MetalLB

- MetalLB にはレイヤー 2 モードがありますが、マルチキャストは使用されません。レイヤー 2 モードには、1 つのノードで外部 IP アドレスのトラフィックをすべて転送する欠点があります。

- 外部 IP アドレスの手動割り当て

- クラスターを、外部 IP アドレスをサービスに割り当てるために使用される IP アドレスブロックで設定できます。デフォルトでは、この機能は無効にされています。この機能は柔軟性がありますが、クラスターまたはネットワーク管理者に最大の負担をかけます。クラスターは外部 IP アドレス宛のトラフィックを受信する準備ができていますが、トラフィックをノードにルーティングする方法はユーザーが決定する必要があります。

2.2. サービスの ExternalIP の設定

クラスター管理者として、クラスター外部の IP アドレスブロックを選択し、クラスター内のサービスにトラフィックを送信することができます。この機能は通常、ベアメタルハードウェアにインストールされているクラスターに最も役立ちます。

サービスに外部 IP アドレスを設定する前に、ネットワークインフラストラクチャーが外部 IP アドレス宛のトラフィックをクラスターにルーティングする必要があります。

2.2.1. ExternalIP について

クラウド以外の環境でトラフィックの負荷分散を行うには、ExternalIP 機能を使用して、Service オブジェクトの spec.externalIPs[] パラメーターに外部 IP アドレスを指定します。この設定では、トラフィックをローカルノードにルーティングし、type=NodePort サービスと同様の機能を提供します。

クラウド環境の場合、クラウドの自動デプロイメントのためにロードバランサーサービスを使用し、サービスのエンドポイントをターゲットに設定します。

パラメーターの値を指定すると、OpenShift Container Platform はサービスに追加の仮想 IP アドレスを割り当てます。IP アドレスは、クラスターに定義したサービスネットワークの外部に存在することができます。

ExternalIP はデフォルトで無効になっているため、ExternalIP 機能を有効にすると、外部 IP アドレスへのクラスター内トラフィックがそのサービスに送信されるため、サービスにセキュリティーリスクが生じる可能性があります。この設定は、クラスターユーザーが外部リソース宛ての機密トラフィックをインターセプトできることを意味します。

MetalLB 実装または IP フェイルオーバーデプロイメントのいずれかを使用して、次の方法で ExternalIP リソースをサービスに接続できます。

- 外部 IP の自動割り当て

-

OpenShift Container Platform は、

spec.type=LoadBalancerを設定してServiceオブジェクトを作成する際に、IP アドレスをautoAssignCIDRsCIDR ブロックからspec.externalIPs[]配列に自動的に割り当てます。この設定では、OpenShift Container Platform はロードバランサーサービスタイプのクラウドバージョンを実装し、サービスに IP アドレスを割り当てます。自動割り当てはデフォルトでは無効になっており、クラスター管理者が「ExternalIP の設定」セクションの説明に従い設定する必要があります。 - 外部 IP の手動割り当て

-

OpenShift Container Platform は

Serviceオブジェクトの作成時にspec.externalIPs[]配列に割り当てられた IP アドレスを使用します。別のサービスによってすでに使用されている IP アドレスを指定することはできません。

MetalLB 実装または IP フェイルオーバーデプロイメントのいずれかを使用して外部 IP アドレスブロックをホストした後、外部 IP アドレスブロックがクラスターにルーティングされるようにネットワークインフラストラクチャーを設定する必要があります。この設定は、ノードからのネットワークインターフェイスに IP アドレスが設定されていないことを意味します。トラフィックを処理するには、静的な Address Resolution Protocol (ARP) エントリーなどの方法を使用して、ルーティングと外部 IP へのアクセスを設定する必要があります。

OpenShift Container Platform は以下の機能を追加して Kubernetes の ExternalIP 機能を拡張します。

- 設定可能なポリシーでの、ユーザーによる外部 IP アドレスの使用の制限

- 要求時の外部 IP アドレスのサービスへの自動割り当て

2.2.2. ExternalIP の設定

OpenShift Container Platform における外部 IP アドレスの使用を制御するには、Network.config.openshift.io カスタムリソース (CR) でパラメーターを設定できます。

以下のリストは、これらのパラメーターの詳細を示しています。

-

spec.externalIP.autoAssignCIDRsは、サービスの外部 IP アドレスを選択する際にロードバランサーによって使用される IP アドレスブロックを定義します。OpenShift Container Platform は、自動割り当て用の単一 IP アドレスブロックのみをサポートします。手動で ExternalIP をサービスに割り当てる場合は、数に限りのある共有 IP アドレスのポートスペースを管理する必要があるため、この設定はそ手動で設定するよりも少ない手順で行えます。自動割り当てを有効にすると、Cloud Controller Manager Operator は、設定でspec.type=LoadBalancerが定義されているServiceオブジェクトに外部 IP アドレスを割り当てます。 -

spec.externalIP.policyは、IP アドレスを手動で指定する際に許容される IP アドレスブロックを定義します。OpenShift Container Platform は、spec.externalIP.autoAssignCIDRsパラメーターで定義した IP アドレスブロックにポリシールールを適用しません。

ルーティングが正しく行われると、設定された外部 IP アドレスブロックからの外部トラフィックは、サービスが公開する TCP ポートまたは UDP ポートを介してサービスのエンドポイントに到達できます。

クラスター管理者は、ExternalIP へのルーティングを設定する必要があります。割り当てる IP アドレスブロックがクラスター内の 1 つ以上のノードで終了することを確認する必要もあります。詳細は、Kubernetes External IPs を参照してください。

OpenShift Container Platform は、自動と手動の両方の IP アドレス割り当てをサポートしています。このサポートにより、各アドレスが最大 1 つのサービスに割り当てられ、他のサービスによって公開されているポートに関係なく、各サービスが選択したポートを公開できることが保証されます。

OpenShift Container Platform の autoAssignCIDRs で定義された IP アドレスブロックを使用するには、ホストのネットワークに必要な IP アドレスの割り当ておよびルーティングを設定する必要があります。

以下の YAML は、外部 IP アドレスが設定されたサービスを説明しています。

spec.externalIPs[] が設定された Service オブジェクトの例

apiVersion: v1

kind: Service

metadata:

name: http-service

spec:

clusterIP: 172.30.163.110

externalIPs:

- 192.168.132.253

externalTrafficPolicy: Cluster

ports:

- name: highport

nodePort: 31903

port: 30102

protocol: TCP

targetPort: 30102

selector:

app: web

sessionAffinity: None

type: LoadBalancer

status:

loadBalancer:

ingress:

- ip: 192.168.132.253

# ...

クラウドプロバイダープラットフォームでプライベートクラスターを実行する場合は、次の patch コマンドを実行して、Ingress Controller のロードバランサーの公開スコープを internal に変更できます。

$ oc -n openshift-ingress-operator patch ingresscontrollers/ingress-controller-with-nlb --type=merge --patch='{"spec":{"endpointPublishingStrategy":{"loadBalancer":{"scope":"Internal"}}}}'このコマンドを実行すると、Ingress Controller は OpenShift Container Platform アプリケーションのルートへのアクセスを内部ネットワークのみに制限します。

2.2.3. 外部 IP アドレスの割り当てに制限を適用する

クラスター管理者は、IP アドレスブロックを指定してサービスの IP アドレスを許可または拒否できます。制限は、cluster-admin 権限を持たないユーザーにのみ適用されます。クラスター管理者は、サービスの spec.externalIPs[] フィールドを任意の IP アドレスに常に設定できます。

ポリシーの制限を設定する際に、以下のルールが適用されます。

-

policyが{}に設定されている場合、spec.ExternalIPs[]を使用してServiceオブジェクトを作成すると、サービスが失敗します。これは、OpenShift Container Platform のデフォルト設定です。policy: nullの場合も同じ動作になります。 policyが設定され、policy.allowedCIDRs[]またはpolicy.rejectedCIDRs[]のいずれかが設定される場合、以下のルールが適用されます。-

allowedCIDRs[]とrejectedCIDRs[]の両方が設定される場合、rejectedCIDRs[]がallowedCIDRs[]よりも優先されます。 -

allowedCIDRs[]が設定される場合、spec.ExternalIPs[]が設定されているServiceオブジェクトの作成は、指定された IP アドレスが許可される場合にのみ正常に実行されます。 -

rejectedCIDRs[]が設定される場合、spec.ExternalIPs[]が設定されているServiceオブジェクトの作成は、指定された IP アドレスが拒否されていない場合にのみ正常に実行されます。

-

手順

ポリシーオブジェクトのspec.ExternalIP.policyパラメーターに Classless Inter-Domain Routing (CIDR) アドレスブロックを指定することで、IP アドレスポリシーを設定します。policyオブジェクトとその CIDR パラメーターの JSON 形式の例{ "policy": { "allowedCIDRs": [], "rejectedCIDRs": [] } }

2.2.4. ポリシーオブジェクトの例

さまざまな spec.externalIP.policy 設定を理解するには、ポリシーオブジェクトの例 セクションの例を参照してください。

以下の例のポリシーは、外部 IP アドレスが指定されたサービスを OpenShift Container Platform が作成できないようにします。

Service オブジェクトの spec.externalIPs[] に指定された値を拒否するポリシーの例

apiVersion: config.openshift.io/v1

kind: Network

metadata:

name: cluster

spec:

externalIP:

policy: {}

# ...

以下の例では、allowedCIDRs および rejectedCIDRs フィールドの両方が設定されます。

許可される、および拒否される CIDR ブロックの両方を含むポリシーの例

apiVersion: config.openshift.io/v1

kind: Network

metadata:

name: cluster

spec:

externalIP:

policy:

allowedCIDRs:

- 172.16.66.10/23

rejectedCIDRs:

- 172.16.66.10/24

# ...

以下の例では、policy は {} に設定されます。これが設定されている場合、oc get networks.config.openshift.io -o yaml コマンドを使用して設定を表示しても policy パラメーターはコマンド出力に表示されません。policy: null の場合も同じ動作になります。

Service オブジェクトの spec.externalIPs[] に指定された値を許可するポリシーの例

apiVersion: config.openshift.io/v1

kind: Network

metadata:

name: cluster

spec:

clusterNetwork:

- cidr: 10.128.0.0/14

hostPrefix: 23

externalIP:

policy: {}

# ...2.2.5. ExternalIP アドレスブロックの設定

ExternalIP アドレスブロックをよりよく理解するには、cluster という名前のネットワークカスタムリソース (CR) によって定義されている ExternalIP アドレスブロックの設定例を参照してください。ネットワーク CR は config.openshift.io API グループに含まれます。

クラスターのインストール時に、Cluster Version Operator (CVO) は cluster という名前のネットワーク CR を自動的に作成します。このタイプのその他の CR オブジェクトの作成はサポートされていません。

以下の YAML は、Network.config.openshift.io CR の cluster という名前の環境における ExternalIP 設定を記述しています。

apiVersion: config.openshift.io/v1

kind: Network

metadata:

name: cluster

spec:

externalIP:

autoAssignCIDRs: []

policy:

...-

autoAssignCIDRs: サービスへの外部 IP アドレスの自動割り当てに使用できる CIDR 形式の IP アドレスブロックを定義します。1 つの IP アドレス範囲のみが許可されます。 -

ポリシー: サービスへの IP アドレスの手動割り当てに関する制限を定義します。制限が定義されていない場合は、Serviceオブジェクトにspec.externalIPフィールドを指定しても許可されません。デフォルトで、制限は定義されません。

以下の YAML は、Network.config.openshift.io CR の ポリシー スタンザのフィールドを記述しています。

policy:

allowedCIDRs: []

rejectedCIDRs: []-

allowedCIDRs:CIDR 形式で指定された、許可された IP アドレス範囲のリスト。 -

rejectedCIDRs: 拒否された IP アドレス範囲のリスト (CIDR 形式)。

次の設定例では、外部 IP アドレスプールの設定を示します。

以下の YAML は、外部 IP アドレスの自動割り当てを有効にする spec.externalIP.autoAssignCIDRs の 設定例を示しています。

spec.externalIP.autoAssignCIDRs が設定された設定例

apiVersion: config.openshift.io/v1

kind: Network

metadata:

name: cluster

spec:

...

externalIP:

autoAssignCIDRs:

- 192.168.132.254/29

以下の YAML 設定には、許可および拒否される CIDR 範囲のポリシールールを設定する spec.externalIP.policy 設定が含まれています。

apiVersion: config.openshift.io/v1

kind: Network

metadata:

name: cluster

spec:

...

externalIP:

policy:

allowedCIDRs:

- 192.168.132.0/29

- 192.168.132.8/29

rejectedCIDRs:

- 192.168.132.7/322.2.6. クラスターの外部 IP アドレスブロックの設定

クラスター管理者として、外部 IP 設定を設定することで、外部トラフィックがクラスターに到達するための予測可能なエントリーポイントを提供できます。

以下のリストは、これらの外部 IP 設定の詳細を示しています。

-

Serviceオブジェクトのspec.clusterIPフィールドを自動的に設定するために OpenShift Container Platform によって使用される ExternalIP アドレスブロック。 -

IP アドレスを制限するポリシーオブジェクトは

Serviceオブジェクトのspec.clusterIP配列に手動で割り当てられます。

前提条件

-

OpenShift CLI (

oc) をインストールします。 -

cluster-adminロールを持つユーザーとしてクラスターにアクセスできる。

手順

オプション: 現在の外部 IP 設定を表示するには、以下のコマンドを入力します。

$ oc describe networks.config cluster設定を編集するには、以下のコマンドを入力します。

$ oc edit networks.config cluster以下の例のように ExternalIP 設定を変更します。

apiVersion: config.openshift.io/v1 kind: Network metadata: name: cluster spec: ... externalIP: ...-

externalIP:externalIPスタンザの設定を指定します。

-

更新された ExternalIP 設定を確認するには、以下のコマンドを入力します。

$ oc get networks.config cluster -o go-template='{{.spec.externalIP}}{{"\n"}}'

2.2.8. 次のステップ

2.3. Ingress Controller を使用してイングレスクラスターのトラフィックを設定する

Ingress Controller を使用すると、外部ユーザーがクラスター内で実行されているサービスとどのように通信するかを制御できます。

イングレスコントローラーを使用したイングレスクラスタートラフィックの設定ドキュメントに記載されている手順を開始する前に、以下の前提条件を満たしていることを確認してください。クラスター管理者は、以下の前提条件を実行します。

- 要求がクラスターに到達できるように、クラスターネットワーク環境に対して外部ポートをセットアップします。

クラスター管理者ロールを持つユーザーが 1 名以上いることを確認します。このロールをユーザーに追加するには、以下のコマンドを実行します。

$ oc adm policy add-cluster-role-to-user cluster-admin username- 1 つ以上のマスターと 1 つ以上のノードを持つ OpenShift Container Platform クラスターと、クラスターへのネットワークアクセス権を持つクラスター外部のシステムを用意します。この手順では、外部システムがクラスターと同じサブセットにあることを前提とします。別のサブセットの外部システムに必要な追加のネットワーク設定は、このトピックでは扱いません。

2.3.1. Ingress Controller およびルートの使用

Ingress Controller を使用すると、OpenShift Container Platform クラスターへの外部アクセスを許可できます。Ingress Operator は Ingress Controller およびワイルドカード DNS を管理します。

Ingress Controller は外部要求を許可し、設定されたルートに基づいてそれらをプロキシー送信するよう設定されます。これは、HTTP、SNI を使用する HTTPS、SNI を使用する TLS に限定されており、SNI を使用する TLS で機能する Web アプリケーションやサービスには十分な設定です。

管理者と連携して Ingress Controller を設定します。外部要求を許可し、設定されたルートに基づいてそれらをプロキシー送信するように Ingress Controller を設定します。

管理者はワイルドカード DNS エントリーを作成してから Ingress Controller を設定できます。その後は管理者に問い合わせることなく edge Ingress Controller と連携できます。

デフォルトで、クラスター内のすべての Ingress Controller はクラスター内の任意のプロジェクトで作成されたすべてのルートを許可します。Ingress コントローラーには、以下の特徴があります。

- デフォルトでは 2 つのレプリカを持つため、2 つのコンピュートノードで実行する必要があります。

- 追加のノードにレプリカを組み込むためにスケールアップすることができます。

2.3.2. プロジェクトおよびサービスの作成

公開するプロジェクトとサービスが存在しない場合は、プロジェクトを作成してからサービスを作成します。

プロジェクトとサービスがすでに存在する場合は、サービスを公開してルートを作成する手順に進みます。

前提条件

-

OpenShift CLI (

oc) をインストールし、クラスター管理者としてログインしている。

手順

oc new-projectコマンドを実行して、サービス用の新しいプロジェクトを作成します。$ oc new-project <project_name>oc new-appコマンドを使用してサービスを作成します。$ oc new-app nodejs:12~https://github.com/sclorg/nodejs-ex.gitサービスが作成されたことを確認するには、以下のコマンドを実行します。

$ oc get svc -n <project_name>出力例

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE nodejs-ex ClusterIP 172.30.197.157 <none> 8080/TCP 70s注記デフォルトで、新規サービスには外部 IP アドレスがありません。

2.3.3. ルートの作成によるサービスの公開

OpenShift Container Platform 上で動作するアプリケーションへの外部アクセスを有効にするには、oc expose コマンドを使用してサービスをルートとして公開します。

前提条件

- OpenShift Container Platform にログインしている。

手順

公開するサービスが置かれているプロジェクトにログインします。

$ oc project <project_name>oc expose serviceコマンドを実行して、ルートを公開します。$ oc expose service nodejs-ex出力例

route.route.openshift.io/nodejs-ex exposedサービスが公開されていることを確認するには、

curlなどのツールを使用して、クラスター外からサービスにアクセスできることを確認します。ルートのホスト名を見つけるには、次のコマンドを入力します。

$ oc get route出力例

NAME HOST/PORT PATH SERVICES PORT TERMINATION WILDCARD nodejs-ex nodejs-ex-myproject.example.com nodejs-ex 8080-tcp Noneホストが GET 要求に応答することを確認するには、次のコマンドを入力します。

curlコマンドの例$ curl --head nodejs-ex-myproject.example.com出力例

HTTP/1.1 200 OK ...

2.3.4. OpenShift Container Platform での Ingress シャーディング

OpenShift Container Platform でルーティングのパフォーマンスを最適化するには、シャードを作成して、複数の Ingress Controller 間で受信トラフィックの負荷分散を行います。

OpenShift Container Platform では、Ingress Controller はすべてのルートを提供することも、ルートのサブセットを提供することもできます。デフォルトでは、イングレスコントローラーはクラスター内のどの名前空間で作成されたルートでも処理します。クラスターに Ingress コントローラーを追加することで、選択した特性に基づいてルートのサブセットであるシャードを作成し、ルーティングを最適化できます。ルートをシャードのメンバーとしてマークするには、ルートまたは namespace の メタデータ フィールドでラベルを使用します。Ingress Controller は、選択式 とも呼ばれる セレクター を使用して、ルートのプール全体からルートのサブセットを選択し、サービスを提供します。

トラフィックを分離して特定のイングレスコントローラーにルーティングしたい場合は、イングレスシャーディングを使用することもできます。

デフォルトでは、各ルートはクラスターのデフォルトドメインを使用します。ただし、代わりにルーターのドメインを使用するようにルートを設定できます。

2.3.5. Ingress Controller のシャーディング

Ingress シャーディング (ルーターシャーディング とも呼ばれる) を使用すると、ルート、名前空間、またはその両方にラベルを追加することで、一連のルートを複数のルーターに分散させることができます。

Ingress Controller は、対応する一連のセレクターを使用して、指定されたラベルが含まれるルートのみを許可します。各 Ingress シャードは、特定の選択式を使用してフィルタリングされたルートで構成されます。

トラフィックがクラスターに送信される主要なメカニズムとして、Ingress Controller への要求が大きくなる可能性があります。クラスター管理者として、以下のコンポーネントにルートをシャーディングできます。

- Ingress Controller またはルーターを複数のルートに分散し、変更に対する応答を高速化する。

- 特定のルートに、他のルートとは異なる信頼性保証を割り当てる。

- 特定の Ingress Controller に異なるポリシーを定義することを許可します。

- 特定のルートのみが追加機能を使用することを許可します。

- たとえば、異なるアドレスで異なるルートを公開し、内部ユーザーおよび外部ユーザーが異なるルートを認識できるようにします。

- Blue-Green デプロイ時に、あるバージョンのアプリケーションから別のバージョンにトラフィックを転送する。

Ingress Controller がシャーディングされると、特定のルートがグループ内の 0 個以上の Ingress Controller に受け入れられます。ルートのステータスから、Ingress Controller がルートを許可したかどうかがわかります。Ingress Controller は、ルートがシャードに固有のものである場合にのみルートを許可します。

シャーディングを使用すると、ルートのサブセットを複数の Ingress Controller に分散できます。ルートのサブセットは、重複なし (従来 のシャーディング) にすることも、重複あり (オーバーラップ シャーディング) にすることもできます。

次の表に、3 つのシャーディング方法の概要を示します。

| シャーディング方法 | 説明 |

|---|---|

| namespace セレクター | Ingress Controller に namespace セレクターを追加すると、namespace セレクターに一致するラベルを持つ namespace 内のすべてのルートが Ingress シャードに追加されます。namespace 内に作成されたすべてのルートを Ingress Controller で提供する場合は、この方法を検討してください。 |

| ルートセレクター | Ingress Controller にルートセレクターを追加すると、ルートセレクターに一致するラベルを持つすべてのルートが Ingress シャードに追加されます。ルートのサブセットのみ、または namespace 内の特定のルートのみを Ingress Controller で提供する場合は、この方法を検討してください。 |

| namespace およびルートセレクター | namespace セレクターとルートセレクター両方の方法で Ingress Controller のスコープを指定します。namespace セレクターとルートセレクター両方の方法の柔軟性が必要な場合は、この方法を検討してください。 |

2.3.5.1. 従来のシャーディングの例

従来のシャーディングを理解するには、キーの値が finance と ops に設定されたラベルセレクター spec.namespaceSelector.matchExpressions を持つ設定済みの Ingress Controller finops-router の例を参照してください。

finops-router の YAML 定義の例

apiVersion: operator.openshift.io/v1

kind: IngressController

metadata:

name: finops-router

namespace: openshift-ingress-operator

spec:

namespaceSelector:

matchExpressions:

- key: name

operator: In

values:

- finance

- ops

キー値が dev に設定されたラベルセレクター spec.namespaceSelector.matchLabels.name を持つ、設定済みの Ingress Controller dev-router の例:

dev-router の YAML 定義の例

apiVersion: operator.openshift.io/v1

kind: IngressController

metadata:

name: dev-router

namespace: openshift-ingress-operator

spec:

namespaceSelector:

matchLabels:

name: dev

すべてのアプリケーションルートが、それぞれ name:finance、name:ops、name:dev などのラベルが付けられた別々の namespace にある場合は、設定によって 2 つの Ingress Controller 間でルートが効果的に分散されます。コンソール、認証、およびその他の目的の OpenShift Container Platform ルートは処理しないでください。

前のシナリオでは、シャーディングは重複するサブセットを持たないパーティション設定の特別なケースとなります。ルートは複数のルーターシャード間で分割されます。

デフォルト の Ingress Controller は、namespaceSelector または routeSelector フィールドに除外対象のルートが含まれていない限り、引き続きすべてのルートを提供します。デフォルトの Ingress Controller からルートを除外する方法の詳細は、この Red Hat ナレッジベースのソリューション と「デフォルトの Ingress Controller のシャーディング」のセクションを参照してください。

2.3.5.2. 重複シャーディングの例

キー値が dev と ops に設定されたラベルセレクター spec.namespaceSelector.matchExpressions を持つ、設定済みの Ingress Controller devops-router の例:

devops-router の YAML 定義の例

apiVersion: operator.openshift.io/v1

kind: IngressController

metadata:

name: devops-router

namespace: openshift-ingress-operator

spec:

namespaceSelector:

matchExpressions:

- key: name

operator: In

values:

- dev

- ops

name:dev および name:ops という 名前の namespace のルートは、2 つの異なる Ingress Controller によって処理されるようになりました。この設定では、ルートのサブセットが重複しています。

重複するルートのサブセットを使用すると、より複雑なルーティングルールを作成できます。たとえば、優先度の低いトラフィックを devops-router に送信しながら、優先度の高いトラフィックを専用の finops-router に迂回させることができます。

2.3.5.3. デフォルトの Ingress Controller のシャーディング

名前空間セレクターまたはルートセレクターを使用することで、特定のラベルを持つルートを Ingress コントローラーが処理しないように制限できます。

新しい Ingress シャードを作成した後に、デフォルトの Ingress Controller と、新しい Ingress シャードの両方により許可されるルートが存在する場合があります。これは、デフォルトの Ingress Controller にセレクターがなく、デフォルトですべてのルートを許可するためです。

以下の手順では、名前空間セレクターを使用することで、デフォルトの Ingress コントローラーが新しくシャーディングされた finance、ops、dev ルートを処理しないように制限します。これにより、Ingress シャードがさらに分離されます。

OpenShift Container Platform のすべての管理ルートを同じ Ingress Controller で保持する必要があります。したがって、これらの重要なルートを除外するセレクターをデフォルトの Ingress Controller に追加することは避けてください。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 - プロジェクト管理者としてログインしている。

手順

次のコマンドを実行して、デフォルトの Ingress Controller を変更します。

$ oc edit ingresscontroller -n openshift-ingress-operator defaultIngress Controller を編集して、

finance、ops、およびdevラベルのいずれかを持つルートを除外するnamespaceSelectorを含めます。apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: namespaceSelector: matchExpressions: - key: name operator: NotIn values: - finance - ops - devデフォルトの Ingress コントローラーは

、name:finance、name:ops、name:devというラベルが付いた名前空間を処理できなくなりました。

2.3.5.4. Ingress シャーディングと DNS

クラスター管理者として、プロジェクト内の各ルーターに対して個別の DNS エントリーを追加するようにしてください。ルーターは不明なルートを別のルーターに転送することはありません。

以下の例を考慮してください。

-

Router A はホスト 192.168.0.5 にあり、

*.foo.comのルートを持つ。 -

Router B はホスト 192.168.1.9 にあり、

*.example.comのルートを持つ。

個別の DNS エントリーは、*.foo.com をルーター A をホストするノードに解決し、*.example.com をルーター B をホストするノードに解決する必要があります。

-

*.foo.com A IN 192.168.0.5 -

*.example.com A IN 192.168.1.9

2.3.5.5. ルートラベルを使用した Ingress Controller のシャーディングの設定

ルートラベルを使用すると、Ingress Controller のシャーディングを設定して、ルートセレクターによって選択された任意の名前空間内の任意のルートを Ingress Controller が処理するようにすることができます。

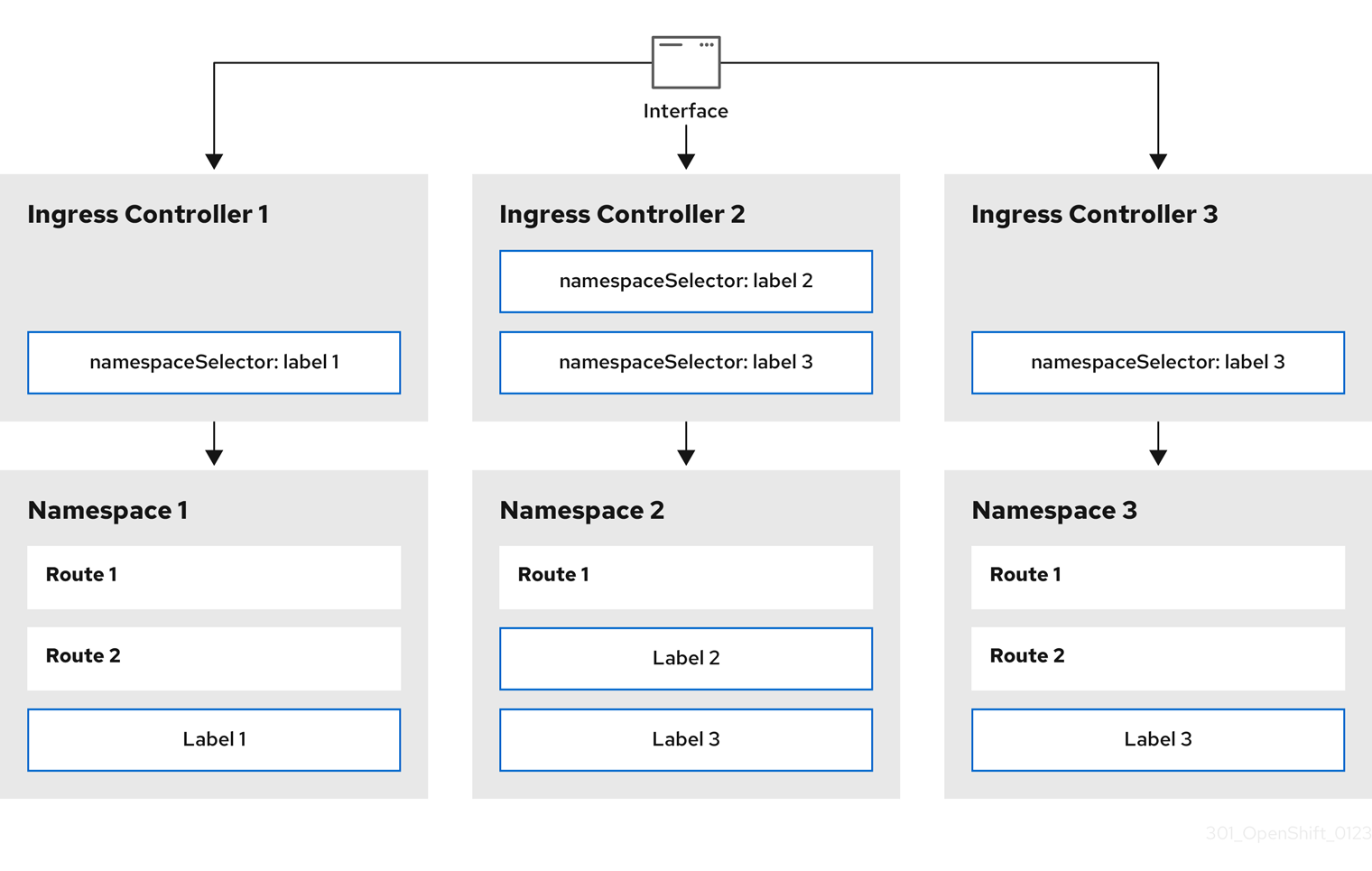

図2.1 ルートラベルを使用したイングレスのシャーディング

Ingress Controller のシャーディングは、一連の Ingress Controller 間で着信トラフィックの負荷を分散し、トラフィックを特定の Ingress Controller に分離する際に役立ちます。たとえば、Company A のトラフィックをある Ingress Controller に指定し、Company B を別の Ingress Controller に指定できます。

手順

router-internal.yamlファイルを編集します。apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: sharded namespace: openshift-ingress-operator spec: domain: <apps-sharded.basedomain.example.net> nodePlacement: nodeSelector: matchLabels: node-role.kubernetes.io/worker: "" routeSelector: matchLabels: type: sharded-

<apps-sharded.basedomain.example.net>: Ingress Controller で使用するドメインを指定します。このドメインは、デフォルトの Ingress Controller ドメインとは異なる必要があります。

-

Ingress Controller の

router-internal.yamlファイルを適用します。# oc apply -f router-internal.yamlIngress Controller は、

type: shardedというラベルのある namespace のルートを選択します。router-internal.yamlで設定されたドメインを使用して、新しいルートを作成します。$ oc expose svc <service-name> --hostname <route-name>.apps-sharded.basedomain.example.net

2.3.5.6. namespace ラベルを使用した Ingress Controller のシャーディングの設定

名前空間ラベルを使用すると、Ingress Controller のシャーディングを設定して、名前空間セレクターによって選択された任意の名前空間内の任意のルートを Ingress Controller が処理するようにすることができます。

図2.2 名前空間ラベルを使用したイングレスのシャーディング

Ingress Controller のシャーディングは、一連の Ingress Controller 間で着信トラフィックの負荷を分散し、トラフィックを特定の Ingress Controller に分離する際に役立ちます。たとえば、Company A のトラフィックをある Ingress Controller に指定し、Company B を別の Ingress Controller に指定できます。

手順

router-internal.yamlファイルを編集します。$ cat router-internal.yaml出力例

apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: sharded namespace: openshift-ingress-operator spec: domain: <apps-sharded.basedomain.example.net> nodePlacement: nodeSelector: matchLabels: node-role.kubernetes.io/worker: "" namespaceSelector: matchLabels: type: sharded-

<apps-sharded.basedomain.example.net>: Ingress Controller で使用するドメインを指定します。このドメインは、デフォルトの Ingress Controller ドメインとは異なる必要があります。

-

Ingress Controller の

router-internal.yamlファイルを適用します。$ oc apply -f router-internal.yamlIngress Controller は、

type: shardedというラベルのある namespace セレクターによって選択される namespace のルートを選択します。router-internal.yamlで設定されたドメインを使用して、新しいルートを作成します。$ oc expose svc <service-name> --hostname <route-name>.apps-sharded.basedomain.example.net

2.3.5.7. Ingress Controller シャーディングのルート作成

ルートを使用すると、アプリケーションを URL でホストできます。Ingress Controller のシャーディングは、一連の Ingress Controller 間での着信トラフィック負荷のバランスをとるのに役立ちます。Ingress Controller のシャーディング機能を使用すると、トラフィックを特定の Ingress Controller に分離することもできます。たとえば、Company A のトラフィックをある Ingress Controller に指定し、Company B を別の Ingress Controller に指定できます。

以下の手順では、例として hello-openshift アプリケーションを使用して、Ingress Controller シャーディングのルートを作成する方法を説明します。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 - プロジェクト管理者としてログインしている。

- ポートを公開する Web アプリケーションと、そのポート上のトラフィックをリッスンする HTTP または TLS エンドポイントがある。

- シャーディング用に Ingress Controller を設定している。

手順

次のコマンドを実行して、

hello-openshiftというプロジェクトを作成します。$ oc new-project hello-openshift以下のコマンドを実行してプロジェクトに Pod を作成します。

$ oc create -f https://raw.githubusercontent.com/openshift/origin/master/examples/hello-openshift/hello-pod.json以下のコマンドを実行して、

hello-openshiftというサービスを作成します。$ oc expose pod/hello-openshifthello-openshift-route.yamlというルート定義を作成します。シャーディング用に作成したルートの YAML 定義

apiVersion: route.openshift.io/v1 kind: Route metadata: labels: type: sharded name: hello-openshift-edge namespace: hello-openshift spec: subdomain: hello-openshift tls: termination: edge to: kind: Service name: hello-openshiftここでは、以下のようになります。

type-

ラベルキーとその対応するラベル値は、Ingress Controller で指定されたものと一致する必要があることを指定します。この例では、Ingress Controller にはラベルキーと値

type: shardedがあります。 subdomain-

サブドメインフィールドの値を使用して公開されるルートを指定します。subdomainフィールドを指定するときは、ホスト名を未設定のままにしておく必要があります。ホストフィールドとサブドメインフィールドの両方を指定した場合、ルートはホストフィールドの値を使用し、サブドメインフィールドは無視します。

次のコマンドを実行し、

hello-openshift-route.yamlを使用してhello-openshiftアプリケーションへのルートを作成します。$ oc -n hello-openshift create -f hello-openshift-route.yaml

検証

次のコマンドを使用して、ルートのステータスを取得します。

$ oc -n hello-openshift get routes/hello-openshift-edge -o yaml結果の

Routeリソースは次のようになります。出力例

apiVersion: route.openshift.io/v1 kind: Route metadata: labels: type: sharded name: hello-openshift-edge namespace: hello-openshift spec: subdomain: hello-openshift tls: termination: edge to: kind: Service name: hello-openshift status: ingress: - host: hello-openshift.<apps-sharded.basedomain.example.net> routerCanonicalHostname: router-sharded.<apps-sharded.basedomain.example.net> routerName: shardedここでは、以下のようになります。

host-

イングレスコントローラー (ルーター) がルートを公開するために使用するホスト名を指定します。

hostフィールドの値は、Ingress Controller によって自動的に決定され、そのドメインを使用します。この例では、Ingress Controller のドメインは<apps-sharded.basedomain.example.net>です。 <apps-sharded.basedomain.example.net>- Ingress コントローラーのホスト名を指定します。ホスト名が設定されていない場合、ルートは代わりにサブドメインを使用できます。サブドメインを指定すると、ルートを公開する Ingress Controller のドメインが自動的に使用されます。ルートが複数の Ingress Controller によって公開される場合、ルートは複数の URL でホストされます。

routerName-

Ingress コントローラーの名前を指定します。この例では、Ingress Controller の名前は

shardedです。

2.3.5.8. 関連情報

2.4. Ingress Controller エンドポイント公開戦略の設定

Ingress Controller のエンドポイントを外部システムに公開し、OpenShift Container Platform でロードバランサーとの統合を有効にするには、endpointPublishingStrategy パラメーターを設定します。

Red Hat OpenStack Platform (RHOSP) では、クラウドプロバイダーがヘルスモニターを作成するように設定されている場合にのみ、LoadBalancerService エンドポイントの公開ストラテジーがサポートされます。RHOSP 16.2 の場合、このストラテジーは Amphora Octavia プロバイダーを使用する場合にのみ可能です。

詳細は、RHOSP インストールドキュメントの「RHOSP Cloud Controller Manager オプションの設定」セクションを参照してください。

2.4.1. Ingress Controller エンドポイントの公開ストラテジー

OpenShift Container Platform で Ingress Controller エンドポイントを外部ネットワークに公開するには、NodePortService エンドポイント公開ストラテジーまたは HostNetwork エンドポイント公開ストラテジーのいずれかを設定します。

NodePortServiceエンドポイント公開ストラテジー-

NodePortServiceエンドポイント公開ストラテジーは、Kubernetes NodePort サービスを使用して Ingress Controller を公開します。

この設定では、Ingress Controller のデプロイメントはコンテナーのネットワークを使用します。NodePortService はデプロイメントを公開するために作成されます。特定のノードポートは OpenShift Container Platform によって動的に割り当てられますが、静的ポートの割り当てをサポートするために、管理対象の NodePortService のノードポートフィールドへの変更が保持されます。

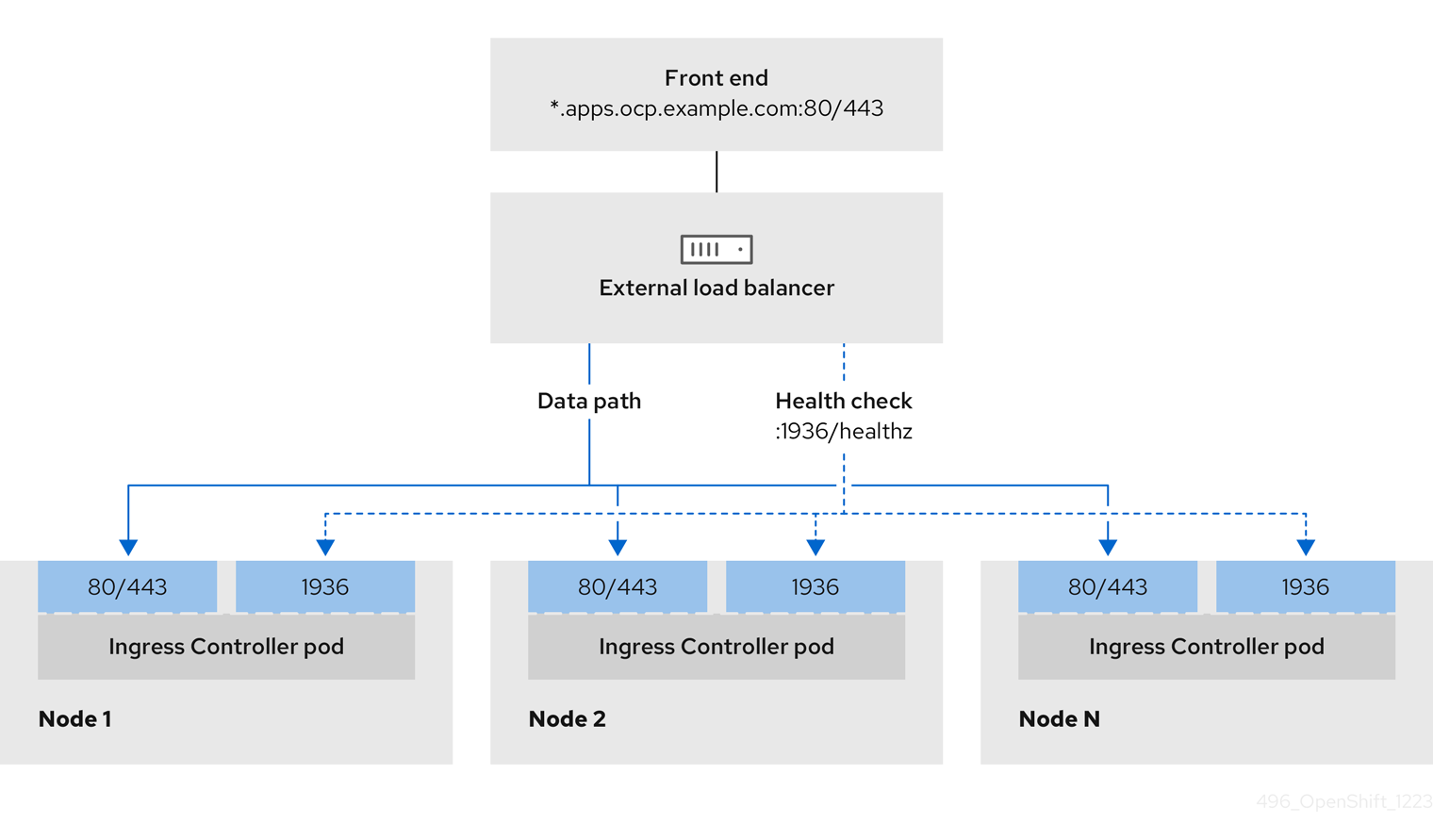

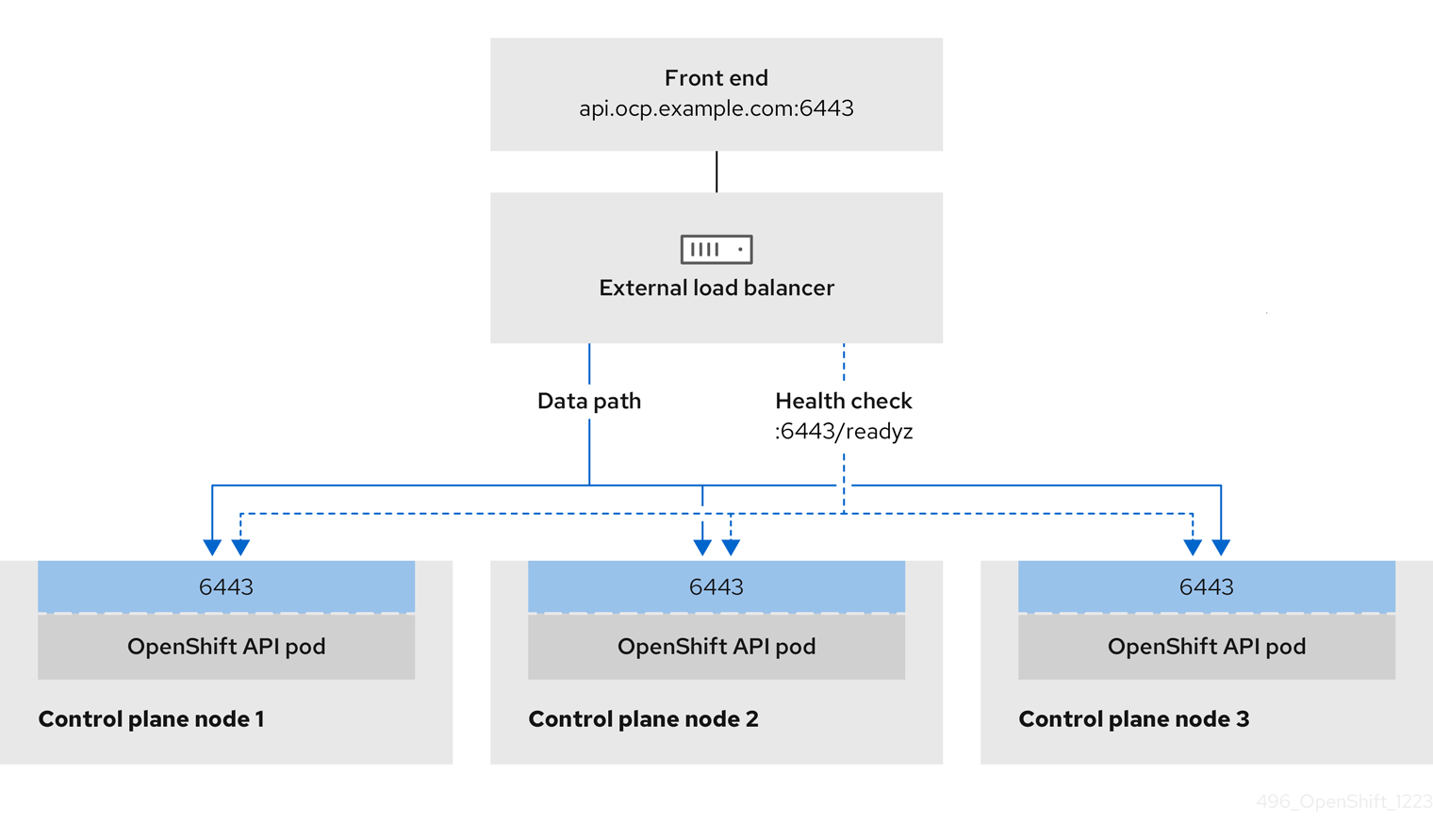

図2.3 NodePortService の図

前述の図では、OpenShift Container Platform Ingress NodePort エンドポイントの公開戦略に関する以下のような概念を示しています。

- クラスターで利用可能なノードにはすべて、外部からアクセス可能な独自の IP アドレスが割り当てられています。クラスター内で動作するサービスは、全ノードに固有の NodePort にバインドされます。

-

たとえば、クライアントが図に示す IP アドレス

10.0.128.4に接続してダウンしているノードに接続した場合に、ノードポートは、サービスを実行中で利用可能なノードにクライアントを直接接続します。このシナリオでは、ロードバランシングは必要ありません。イメージが示すように、10.0.128.4アドレスがダウンしており、代わりに別の IP アドレスを使用する必要があります。

Ingress Operator は、サービスの .spec.ports[].nodePort フィールドへの更新を無視します。

デフォルトで、ポートは自動的に割り当てられ、各種の統合用のポート割り当てにアクセスできます。ただし、既存のインフラストラクチャーと統合するために静的ポートの割り当てが必要になることがありますが、これは動的ポートに対応して簡単に再設定できない場合があります。静的ノードポートとの統合を実行するには、マネージドのサービスリソースを直接更新できます。

詳細は、NodePort に関する Kubernetes サービスのドキュメント を参照してください。

ホストネットワークエンドポイント公開ストラテジー*-

HostNetworkエンドポイント公開ストラテジーは、Ingress Controller がデプロイされるノードポートで Ingress Controller を公開します。

HostNetwork エンドポイント公開ストラテジーを持つ Ingress Controller には、ノードごとに 1 つの Pod レプリカのみを設定できます。n のレプリカを使用する場合、それらのレプリカをスケジュールできる n 以上のノードを使用する必要があります。各 Pod はスケジュールされるノードホストでポート 80 および 443 を要求するので、同じノードで別の Pod がそれらのポートを使用している場合、レプリカをノードにスケジュールすることはできません。

HostNetwork オブジェクトには、オプションのバインディングポートのデフォルト値が httpPort:80、httpsPort:443、statsPort:1936 の hostNetwork フィールドがあります。ネットワークに異なるバインディングポートを指定することで、HostNetwork ストラテジーに対して、同じノードに複数の Ingress Controller をデプロイできます。

例

apiVersion: operator.openshift.io/v1

kind: IngressController

metadata:

name: internal

namespace: openshift-ingress-operator

spec:

domain: example.com

endpointPublishingStrategy:

type: HostNetwork

hostNetwork:

httpPort: 80

httpsPort: 443

statsPort: 19362.4.1.1. Ingress Controller エンドポイント公開スコープの内部への設定

クラスター管理者として、クラスターがプライベートであることを指定せずに新しいクラスターをインストールすると、デフォルトの Ingress コントローラーが 外部スコープ に設定された状態で作成されます。外部 スコープのイングレスコントローラーを 内部スコープ に変更できます。

前提条件

-

OpenShift CLI (

oc) がインストールされている。

手順

外部スコープのイングレスコントローラーを内部スコープに変更するには、次のコマンドを入力します。$ oc -n openshift-ingress-operator patch ingresscontrollers/default --type=merge --patch='{"spec":{"endpointPublishingStrategy":{"type":"LoadBalancerService","loadBalancer":{"scope":"Internal"}}}}'

検証

Ingress Controller のステータスを確認するには、次のコマンドを入力します。

$ oc -n openshift-ingress-operator get ingresscontrollers/default -o yamlステータス状態が

Progressingの場合は、さらにアクションを実行する必要があるかどうかを示します。たとえば、ステータスの状態によっては、次のコマンドを入力して、サービスを削除する必要があることを示している可能性があります。$ oc -n openshift-ingress delete services/router-defaultサービスを削除すると、Ingress Operator はサービスを

Internalとして再作成します。

2.4.1.2. Ingress Controller エンドポイント公開スコープの外部への設定

インストール時またはインストール後のタスクとして、クラスター管理者は Ingress Controller を Internal に設定できます。さらに、クラスター管理者は 内部 イングレスコントローラーを 外部イングレス コントローラーに変更できます。

クラスターがプライベートであることを指定せずに新しいクラスターをインストールすると、デフォルトの Ingress コントローラーが スコープ を External に設定して作成されます。

一部のプラットフォームでは、サービスを削除して再作成する必要があります。

スコープを変更すると、場合によっては数分間、Ingress トラフィックが中断される可能性があります。これが該当するのは、サービスを削除して再作成する必要があるプラットフォームです。理由は、この手順により、OpenShift Container Platform が既存のサービスロードバランサーのプロビジョニングを解除して新しいサービスロードバランサーをプロビジョニングし、DNS を更新する可能性があるためです。

前提条件

-

OpenShift CLI (

oc) がインストールされている。

手順

内部スコープのイングレスコントローラーを外部スコープに変更するには、次のコマンドを入力します。$ oc -n openshift-ingress-operator patch ingresscontrollers/private --type=merge --patch='{"spec":{"endpointPublishingStrategy":{"type":"LoadBalancerService","loadBalancer":{"scope":"External"}}}}'

検証

Ingress Controller のステータスを確認するには、次のコマンドを入力します。

$ oc -n openshift-ingress-operator get ingresscontrollers/default -o yamlステータス状態が

Progressingの場合は、さらにアクションを実行する必要があるかどうかを示します。たとえば、ステータスの状態によっては、次のコマンドを入力して、サービスを削除する必要があることを示している可能性があります。$ oc -n openshift-ingress delete services/router-defaultサービスを削除すると、Ingress Operator はサービスを

Externalとして再作成します。

2.4.1.3. Ingress Controller への単一の NodePort サービスの追加

ポートの競合を防ぐため、プロジェクトごとに NodePort タイプの サービス を作成する代わりに、NodePortService エンドポイント公開ストラテジーを使用できるカスタム Ingress コントローラーを作成します。

すでに HostNetwork Ingress Controller がインストールされている可能性のあるノードに、Ingress シャーディングを通じて一連のルートを適用したい場合は、Ingress Controller にこの設定を検討してください。

各プロジェクトに NodePort タイプの Service を設定する前に、次の考慮事項を確認してください。

-

NodeportIngress Controller ドメインに対して、ワイルドカード DNS レコードを作成する必要があります。Nodeport Ingress Controller ルートには、ワーカーノードのアドレスからアクセスできます。ルートに必要な DNS レコードの詳細は、「user-provisioned DNS 要件」を参照してください。 -

サービス用のルートを公開し、カスタム Ingress Controller ドメインの

--hostname引数を指定する必要があります。 -

アプリケーション Pod にアクセスできるようにするには、

NodePortタイプのServiceに割り当てられているポートをルートに追加する必要があります。

前提条件

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-admin権限を持つユーザーとしてログインしている。 - ワイルドカード DNS レコードが作成されている。

手順

Ingress Controller のカスタムリソース (CR) ファイルを作成します。

IngressControllerオブジェクトの情報を定義する CR ファイルの例apiVersion: v1 items: - apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: <custom_ic_name> namespace: openshift-ingress-operator spec: replicas: 1 domain: <custom_ic_domain_name> nodePlacement: nodeSelector: matchLabels: <key>: <value> namespaceSelector: matchLabels: <key>: <value> endpointPublishingStrategy: type: NodePortService # ...ここでは、以下のようになります。

metadata.name-

IngressControllerCR のカスタム名を指定します。 仕様ドメイン-

Ingress Controller がサービスを提供する DNS 名を指定します。たとえば、デフォルトのイングレスコントローラーのドメインは

apps.ipi-cluster.example.comなので、<custom_ic_domain_name>にはnodeportsvc.ipi-cluster.example.comを指定します。 nodeSelector.matchLabels.<key>- カスタム Ingress コントローラーを含むノードのラベルを指定します。

namespaceSelector.matchLabels.<key>-

一連の名前空間のラベルを指定します。

<key>:<value>は、キーと値のペアのマップに置き換えます。<key>は新しいラベルの一意の名前、<value>はその値です。たとえば、ingresscontroller: custom-icです。

oc label nodeコマンドを使用してノードにラベルを追加します。$ oc label node <node_name> <key>=<value>-

<key>=<value>: ここで、<value> はIngressControllerCR のnodePlacementセクションで指定されたキーと値のペアと一致する必要があります。

-

IngressControllerオブジェクトを作成します。$ oc create -f <ingress_controller_cr>.yamlIngressControllerCR 用に作成されたサービスのポートを確認します。$ oc get svc -n openshift-ingressrouter-nodeport-custom-ic3サービスのポート80:32432/TCPを示す出力例NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE router-internal-default ClusterIP 172.30.195.74 <none> 80/TCP,443/TCP,1936/TCP 223d router-nodeport-custom-ic3 NodePort 172.30.109.219 <none> 80:32432/TCP,443:31366/TCP,1936:30499/TCP 155m新しいプロジェクトを作成するために、次のコマンドを入力します。

$ oc new-project <project_name>新しい namespace にラベルを付けるために、次のコマンドを入力します。

$ oc label namespace <project_name> <key>=<value>-

<key>=<value>:: ここで、<key>=<value> はIngress Controller CR のnamespaceSelectorセクションの値と一致する必要があります。

-

クラスター内に新しいアプリケーションを作成します。

$ oc new-app --image=<image_name>-

<image_name>:<image_name>の例はquay.io/openshifttest/hello-openshift:multiarchです。

-

サービスの

Routeオブジェクトを作成して、Pod がサービスを使用してアプリケーションをクラスターの外部に公開できるようにします。$ oc expose svc/<service_name> --hostname=<svc_name>-<project_name>.<custom_ic_domain_name>注記--hostname引数で、カスタム Ingress Controller のドメイン名を指定する必要があります。これを行わない場合、Ingress Operator がデフォルトの Ingress Controller を使用してクラスターのすべてのルートを提供します。ルートのステータスが

Admittedであり、カスタム Ingress Controller のメタデータがルートに含まれていることを確認します。$ oc get route/hello-openshift -o json | jq '.status.ingress'出力例

# ... { "conditions": [ { "lastTransitionTime": "2024-05-17T18:25:41Z", "status": "True", "type": "Admitted" } ], [ { "host": "hello-openshift.nodeportsvc.ipi-cluster.example.com", "routerCanonicalHostname": "router-nodeportsvc.nodeportsvc.ipi-cluster.example.com", "routerName": "nodeportsvc", "wildcardPolicy": "None" } ], }デフォルトの

IngressControllerCR を更新して、デフォルトの Ingress Controller がNodePortタイプのServiceを管理しないようにします。他のすべてのクラスタートラフィックは、引き続きデフォルトの Ingress Controller によって監視します。$ oc patch --type=merge -n openshift-ingress-operator ingresscontroller/default --patch '{"spec":{"namespaceSelector":{"matchExpressions":[{"key":"<key>","operator":"NotIn","values":["<value>]}]}}}'

検証

次のコマンドを入力して、DNS エントリーがクラスターの内外にルーティングできることを確認します。このコマンドでは、上記の手順で

oc label nodeコマンドを実行してラベルを追加したノードの IP アドレスが出力されます。$ dig +short <svc_name>-<project_name>.<custom_ic_domain_name>クラスターが DNS 解決に外部 DNS サーバーの IP アドレスを使用していることを確認するために、次のコマンドを入力してクラスターの接続を確認します。

$ curl <svc_name>-<project_name>.<custom_ic_domain_name>:<port>1 <custom_ic_domain_name>:<port>: ここで、<port>はNodePortタイプのサービスからのノードポートです。oc get svc -n openshift-ingressコマンドの出力例の80:32432/TCPHTTP ルートから、32432がノードポートであることがわかります。出力例

Hello OpenShift!

2.5. ロードバランサーを使用した Ingress クラスターの設定

OpenShift Container Platform は、クラスター内で実行されるサービスを使用してクラスター外からの通信を可能にする方法を提供します。この方法では、ロードバランサーを使用します。

以下の手順を開始する前に、管理者は以下の前提条件となるタスクを完了する必要があります。

- 要求がクラスターに到達できるように、クラスターネットワーク環境に対して外部ポートをセットアップします。

- 少なくとも 1 つのコントロールプレーンノード、少なくとも 1 つのコンピュートノード、およびクラスターへのネットワークアクセスが可能なクラスター外部のシステムを備えた OpenShift Container Platform クラスターを用意してください。この手順では、外部システムがクラスターと同じサブセットにあることを前提とします。別のサブセットの外部システムに必要な追加のネットワーク設定は、このトピックでは扱いません。

クラスター管理者ロールを持つユーザーが 1 名以上いることを確認します。このロールをユーザーに追加するには、以下のコマンドを実行します。

$ oc adm policy add-cluster-role-to-user cluster-admin username

2.5.1. ロードバランサーを使用したトラフィックのクラスターへの送信

特定の外部 IP アドレスを必要としない場合、ロードバランサーサービスを OpenShift Container Platform クラスターへの外部アクセスを許可するよう設定することができます。

ロードバランサーサービスは固有の IP を割り当てます。ロードバランサーには単一の edge ルーター IP があります (これは仮想 IP (VIP) の場合もありますが、初期の負荷分散では単一マシンになります。

プールはインフラストラクチャーレベルで設定され、クラスター管理者レベルでは設定されません。

2.5.2. プロジェクトおよびサービスの作成

公開するプロジェクトとサービスが存在しない場合は、プロジェクトを作成してからサービスを作成します。

プロジェクトとサービスがすでに存在する場合は、サービスを公開してルートを作成する手順に進みます。

前提条件

-

OpenShift CLI (

oc) をインストールし、クラスター管理者としてログインしている。

手順

oc new-projectコマンドを実行して、サービス用の新しいプロジェクトを作成します。$ oc new-project <project_name>oc new-appコマンドを使用してサービスを作成します。$ oc new-app nodejs:12~https://github.com/sclorg/nodejs-ex.gitサービスが作成されたことを確認するには、以下のコマンドを実行します。

$ oc get svc -n <project_name>出力例

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE nodejs-ex ClusterIP 172.30.197.157 <none> 8080/TCP 70s注記デフォルトで、新規サービスには外部 IP アドレスがありません。

2.5.3. ルートの作成によるサービスの公開

OpenShift Container Platform 上で動作するアプリケーションへの外部アクセスを有効にするには、oc expose コマンドを使用してサービスをルートとして公開します。

前提条件

- OpenShift Container Platform にログインしている。

手順

公開するサービスが置かれているプロジェクトにログインします。

$ oc project <project_name>oc expose serviceコマンドを実行して、ルートを公開します。$ oc expose service nodejs-ex出力例

route.route.openshift.io/nodejs-ex exposedサービスが公開されていることを確認するには、

curlなどのツールを使用して、クラスター外からサービスにアクセスできることを確認します。ルートのホスト名を見つけるには、次のコマンドを入力します。

$ oc get route出力例

NAME HOST/PORT PATH SERVICES PORT TERMINATION WILDCARD nodejs-ex nodejs-ex-myproject.example.com nodejs-ex 8080-tcp Noneホストが GET 要求に応答することを確認するには、次のコマンドを入力します。

curlコマンドの例$ curl --head nodejs-ex-myproject.example.com出力例

HTTP/1.1 200 OK ...

2.5.4. ロードバランサーサービスの作成

OpenShift Container Platform でアプリケーションの受信トラフィックを効率的に分散し、高い可用性を確保するには、ロードバランサーサービスを作成します。

前提条件

- 公開するプロジェクトとサービスがあること。

- クラウドプロバイダーがロードバランサーをサポートしている。

手順

- OpenShift Container Platform にログインします。

公開するサービスが置かれているプロジェクトを読み込みます。

コマンドの例

$ oc project project1コントロールプレーンノード上のテキストファイルを開き、以下のテキストをファイルに貼り付けてください。必要に応じてファイルを編集してください。

ロードバランサー設定ファイルのサンプル

apiVersion: v1 kind: Service metadata: name: egress-2 spec: ports: - name: db port: 3306 loadBalancerIP: loadBalancerSourceRanges: - 10.0.0.0/8 - 192.168.0.0/16 type: LoadBalancer selector: name: mysqlここでは、以下のようになります。

metadata.name- ロードバランサーサービスの説明的な名前を指定します。

ポート.ポート- 公開したいサービスがリッスンしているポートと同じポートを指定します。

loadBalancerSourceRanges- ロードバランサーを通過するトラフィックを制限する特定の IP アドレスのリストを指定します。クラウドプロバイダーがこの機能をサポートしていない場合、このパラメーターは無視されます。

type-

タイプとして

ロードバランサーを指定します。 セレクター名サービスの名前を指定します。

注記ロードバランサーを経由するトラフィックを特定の IP アドレスに制限するには、

spec.endpointPublishingStrategy.loadBalancer.allowedSourceRangesIngress Controller パラメーターを使用します。loadBalancerSourceRangesパラメーターを設定しないでください。

- ファイルを保存し、終了します。

以下のコマンドを実行してサービスを作成します。

$ oc create -f <file_name>以下に例を示します。

$ oc create -f mysql-lb.yaml以下のコマンドを実行して新規サービスを表示します。

$ oc get svc出力例

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE egress-2 LoadBalancer 172.30.22.226 ad42f5d8b303045-487804948.example.com 3306:30357/TCP 15m有効にされたクラウドプロバイダーがある場合、サービスには外部 IP アドレスが自動的に割り当てられます。

マスターサーバー上で、

curlなどのツールを使用して、パブリック IP アドレスを使用してサービスにアクセスできることを確認してください。$ curl <public_ip>:<port>以下に例を示します。

$ curl 172.29.121.74:3306このセクションの例では、クライアントアプリケーションを必要とする MySQL サービスを使用しています。

Got packets out of orderのメッセージと共に文字ストリングを取得する場合は、このサービスに接続していることになります。MySQL クライアントがある場合は、標準 CLI コマンドでログインします。

$ mysql -h 172.30.131.89 -u admin -p出力例

Enter password: Welcome to the MariaDB monitor. Commands end with ; or \g. MySQL [(none)]>

2.6. AWS での Ingress クラスタートラフィックの設定