시스템 설계 가이드

RHEL 8 시스템 설계

초록

Red Hat 문서에 관한 피드백 제공

문서 개선을 위한 의견에 감사드립니다. 어떻게 개선할 수 있는지 알려주십시오.

Jira를 통해 피드백 제출 (계정 필요)

- Jira 웹 사이트에 로그인합니다.

- 상단 탐색 모음에서 생성 을 클릭합니다.

- 요약 필드에 설명 제목을 입력합니다.

- 설명 필드에 개선을 위한 제안을 입력합니다. 문서의 관련 부분에 대한 링크를 포함합니다.

- 대화 상자 하단에서 생성 을 클릭합니다.

I 부. 설치 설계

1장. 시스템 요구 사항 및 지원되는 아키텍처

Red Hat Enterprise Linux 8은 적은 노력으로 보다 빠르게 워크로드를 제공하는 데 필요한 툴을 사용하여 하이브리드 클라우드 배포 전반에 걸쳐 안정적이고 안전하며 일관된 기반을 제공합니다. 지원되는 하이퍼바이저 및 클라우드 공급자 환경에 RHEL을 게스트로 배포할 수 있으므로 애플리케이션이 선도적인 하드웨어 아키텍처 플랫폼의 혁신을 활용할 수 있습니다.

설치하기 전에 시스템, 하드웨어, 보안, 메모리, RAID에 제공된 지침을 검토하십시오.

시스템을 가상화 호스트로 사용하려면 가상화에 필요한 하드웨어 요구 사항을 살펴보십시오.

Red Hat Enterprise Linux는 다음과 같은 아키텍처를 지원합니다.

- AMD 및 Intel 64비트 아키텍처

- 64비트 ARM 아키텍처

- IBM Power Systems, Little Endian

- 64비트 IBM Z 아키텍처

1.1. 지원되는 설치 대상

설치 대상은 Red Hat Enterprise Linux를 저장하고 시스템을 부팅하는 스토리지 장치입니다. Red Hat Enterprise Linux는 IBMZ , IBM Power, AMD64, Intel 64 및 64비트 ARM 시스템에 대해 다음과 같은 설치 대상을 지원합니다.

- DASD, SCSI, SATA 또는 SAS와 같은 표준 내부 인터페이스로 연결된 스토리지

- Intel64, AMD64 및 arm64 아키텍처의 BIOS/firmware RAID 장치

-

Intel64 및 AMD64 아키텍처의 섹터 모드의 NVDIMM 장치는

nd_pmem드라이버에서 지원합니다. - DASD(IBM Z 아키텍처만 해당) 및 다중 경로 장치를 포함한 SCSI LUN과 같은 파이버 채널 호스트 버스 어댑터를 통해 연결된 스토리지입니다. 일부에는 벤더 제공 드라이버가 필요할 수 있습니다.

- Cryostat 가상 머신의 Intel 프로세서의 Cryostat 블록 장치입니다.

- KVM 가상 머신의 Intel 프로세서의 virtio 블록 장치.

Red Hat은 USB 드라이브 또는 SD 메모리 카드에 대한 설치를 지원하지 않습니다. 타사 가상화 기술 지원에 대한 자세한 내용은 Red Hat 하드웨어 호환성 목록을 참조하십시오.

1.2. 시스템 사양

Red Hat Enterprise Linux 설치 프로그램은 시스템의 하드웨어를 자동으로 감지하고 설치하므로 특정 시스템 정보를 제공할 필요가 없습니다. 그러나 특정 Red Hat Enterprise Linux 설치 시나리오에서는 나중에 참조할 수 있도록 시스템 사양을 기록하는 것이 좋습니다. 이러한 시나리오에는 다음이 포함됩니다.

사용자 지정 파티션 레이아웃을 사용하여 RHEL 설치

레코드: 시스템에 연결된 디스크의 모델 번호, 크기, 유형 및 인터페이스입니다. 예를 들어 SATA0의 Cryostat ST3320613AS 320GB는 SATA1의 Western Digital WD7500AAKS 750GB입니다.

기존 시스템에서 RHEL을 추가 운영 체제로 설치

레코드: 시스템에서 사용되는 파티션입니다. 이 정보에는 파일 시스템 유형, 장치 노드 이름, 파일 시스템 레이블 및 크기가 포함될 수 있으며 파티션 프로세스 중에 특정 파티션을 식별할 수 있습니다. 운영 체제 중 하나가 Unix 운영 체제인 경우 Red Hat Enterprise Linux는 장치 이름을 다르게 보고할 수 있습니다. 추가 정보는 mount 명령과 blkid 명령과 /etc/fstab 파일에 해당하는 명령을 실행하여 확인할 수 있습니다.

여러 운영 체제가 설치된 경우 Red Hat Enterprise Linux 설치 프로그램은 자동으로 탐지하고 부팅하도록 부트 로더를 구성하려고 합니다. 추가 운영 체제가 자동으로 감지되지 않는 경우 수동으로 구성할 수 있습니다.

로컬 디스크의 이미지에서 RHEL 설치

레코드: 이미지를 보유한 디스크 및 디렉터리입니다.

네트워크 위치에서 RHEL 설치

네트워크를 수동으로 구성해야 하는 경우 DHCP는 사용되지 않습니다.

레코드:

- IP 주소

- 넷마스크

- 게이트웨이 IP 주소

- 필요한 경우 서버 IP 주소

네트워킹 요구 사항에 대한 지원이 필요한 경우 네트워크 관리자에게 문의하십시오.

iSCSI 대상에 RHEL 설치

레코드: iSCSI 대상의 위치입니다. 네트워크에 따라 CHAP 사용자 이름 및 암호와 역방향 CHAP 사용자 이름과 암호가 필요할 수 있습니다.

시스템이 도메인의 일부인 경우 RHEL 설치

도메인 이름이 DHCP 서버에서 제공되었는지 확인합니다. 그렇지 않은 경우 설치 중에 도메인 이름을 입력합니다.

1.3. 디스크 및 메모리 요구 사항

여러 운영 체제가 설치된 경우 할당된 디스크 공간이 Red Hat Enterprise Linux에 필요한 디스크 공간과 분리되어 있는지 확인하는 것이 중요합니다. 경우에 따라 특정 파티션을 Red Hat Enterprise Linux에 전용으로 사용하는 것이 중요합니다(예: AMD64, Intel 64 및 64비트 ARM의 경우 최소 두 개의 파티션(/ 및 스왑)은 RHEL 및 IBM Power Systems 서버의 경우 최소 3개의 파티션(/, swap, PReP 부팅 파티션)을 RHEL로 전용해야 합니다.

또한 최소 10GiB의 사용 가능한 디스크 공간이 있어야 합니다. Red Hat Enterprise Linux를 설치하려면 파티션되지 않은 디스크 공간 또는 삭제할 수 있는 파티션에 최소 10GiB의 공간이 있어야 합니다. 자세한 내용은 파티셔닝 참조를 참조하십시오.

| 설치 유형 | 최소 RAM |

|---|---|

| 로컬 미디어 설치 (USB, DVD) |

|

| NFS 네트워크 설치 |

|

| HTTP, HTTPS 또는 FTP 네트워크 설치 |

|

최소 요구 사항보다 적은 메모리로 설치를 완료할 수 있습니다. 정확한 요구 사항은 환경 및 설치 경로에 따라 다릅니다. 다양한 구성을 테스트하여 환경에 필요한 최소 RAM을 확인합니다. Kickstart 파일을 사용하여 Red Hat Enterprise Linux를 설치하면 표준 설치와 최소 RAM 요구 사항이 있습니다. 그러나 Kickstart 파일에 추가 메모리가 필요한 명령을 포함하거나 RAM 디스크에 데이터를 쓰는 경우 추가 RAM이 필요할 수 있습니다. 자세한 내용은 RHEL 자동 설치를 참조하십시오.

1.4. 그래픽 디스플레이 확인 요구 사항

시스템에 Red Hat Enterprise Linux의 원활하고 오류가 없는 설치를 보장하기 위해 다음과 같은 최소 해결 방법이 있어야 합니다.

| 제품 버전 | 해결 |

|---|---|

| Red Hat Enterprise Linux 8 | 최소: 800 x 600 권장 사항: 1026 x 768 |

1.5. UEFI Secure Boot 및 베타 릴리스 요구 사항

UEFI Secure Boot가 활성화된 시스템에 Red Hat Enterprise Linux 베타 릴리스를 설치하려면 먼저 UEFI Secure Boot 옵션을 비활성화한 다음 설치를 시작합니다.

UEFI Secure Boot를 사용하려면 시스템의 펌웨어가 해당 공개 키를 사용하여 확인하는 인식된 개인 키로 운영 체제 커널에 서명해야 합니다. Red Hat Enterprise Linux 베타 릴리스의 경우 커널은 Red Hat 베타별 공개 키로 서명되어 시스템이 기본적으로 인식되지 않습니다. 결과적으로 시스템은 설치 미디어를 부팅하지 못합니다.

2장. 설치 미디어 사용자 정의

자세한 내용은 사용자 지정 RHEL 시스템 이미지 구성을 참조하십시오.

3장. RHEL의 부팅 가능 설치 미디어 생성

고객 포털에서 ISO 파일을 다운로드하여 USB 또는 DVD와 같은 부팅 가능한 물리적 설치 미디어를 준비할 수 있습니다. RHEL 8부터 Red Hat은 더 이상 서버 및 워크스테이션에 대해 별도의 변형을 제공하지 않습니다. Red Hat Enterprise Linux for x86_64 에는 Server 및 Workstation 기능이 모두 포함되어 있습니다. Server 와 Workstation 간의 차이점은 설치 또는 구성 프로세스 중에 시스템 용도 역할을 통해 관리됩니다.

고객 포털에서 ISO 파일을 다운로드한 후 USB 또는 DVD와 같은 부팅 가능한 물리적 설치 미디어를 생성하여 설치 프로세스를 계속합니다.

USB 드라이브가 금지되는 보안 환경 케이스의 경우 이미지 빌더를 사용하여 참조 이미지를 생성하고 배포하는 것이 좋습니다. 이 방법을 사용하면 시스템 무결성을 유지하면서 보안 정책을 준수할 수 있습니다. 자세한 내용은 이미지 빌더 설명서를 참조하십시오.

기본적으로 inst.stage2= 부팅 옵션은 설치 미디어에서 사용되며 특정 레이블(예: inst.stage2=hd:LABEL=RHEL8\x86_64 )으로 설정됩니다. 런타임 이미지가 포함된 파일 시스템의 기본 레이블을 수정하거나 사용자 지정 절차를 사용하여 설치 시스템을 부팅하는 경우 라벨이 올바른 값으로 설정되어 있는지 확인합니다.

3.1. 설치 부팅 미디어 옵션

Red Hat Enterprise Linux 설치 프로그램을 시작하는 데 사용할 수 있는 몇 가지 옵션이 있습니다.

- 전체 설치 DVD 또는 USB 드라이브

- DVD ISO 이미지를 사용하여 전체 설치 DVD 또는 USB 플래시 드라이브를 만듭니다. DVD 또는 USB 플래시 드라이브를 부팅 장치로 사용하고 소프트웨어 패키지를 설치하기 위한 설치 소스로 사용할 수 있습니다.

- 최소 설치 DVD, CD 또는 USB 플래시 드라이브

- 시스템을 부팅하고 설치 프로그램을 시작하는 데 필요한 최소 파일만 포함하는 Boot ISO 이미지를 사용하여 최소 설치 CD, DVD 또는 USB 플래시 드라이브를 만듭니다. CDN(Content Delivery Network)을 사용하여 필요한 소프트웨어 패키지를 다운로드하지 않는 경우 Boot ISO 이미지에 필요한 소프트웨어 패키지가 포함된 설치 소스가 필요합니다.

- PXE 서버

- PXE(P reboot Execution Environment ) 서버를 사용하면 설치 프로그램이 네트워크를 통해 부팅할 수 있습니다. 시스템을 부팅한 후에는 로컬 디스크 또는 네트워크 위치와 같은 다른 설치 소스의 설치를 완료해야 합니다.

- 이미지 빌더

- 이미지 빌더를 사용하면 사용자 지정 시스템 및 클라우드 이미지를 생성하여 가상 및 클라우드 환경에 Red Hat Enterprise Linux를 설치할 수 있습니다.

3.2. 부팅 가능한 DVD 만들기

굽기 소프트웨어 및 DVD 버너를 사용하여 부팅 가능한 설치 DVD를 만들 수 있습니다. ISO 이미지 파일에서 DVD를 생성하는 정확한 단계는 운영 체제 및 디스크 굽기 소프트웨어에 따라 크게 달라집니다. ISO 이미지 파일에서 DVD를 구울 수있는 정확한 단계는 시스템의 소프트웨어 문서를 참조하십시오.

DVD ISO 이미지(전체 설치) 또는 부팅 ISO 이미지(최소 설치)를 사용하여 부팅 가능한 DVD를 생성할 수 있습니다. 그러나 DVD ISO 이미지는 4.7GB보다 크므로 단일 또는 듀얼 계층 DVD에 적합하지 않을 수 있습니다. 계속하기 전에 DVD ISO 이미지 파일의 크기를 확인하십시오. DVD ISO 이미지를 사용할 때 USB 플래시 드라이브를 사용하여 부팅 가능한 설치 미디어를 생성합니다. USB 드라이브가 금지되는 환경 케이스는 이미지 빌더 설명서를 참조하십시오.

3.3. Linux에서 부팅 가능한 USB 장치 생성

부팅 가능한 USB 장치를 생성한 다음 다른 시스템에 Red Hat Enterprise Linux를 설치할 수 있습니다. 이 절차에서는 경고 없이 USB 드라이브의 기존 데이터를 덮어씁니다. 모든 데이터를 백업하거나 빈 플래시 드라이브를 사용합니다. 데이터 저장에는 부팅 가능한 USB 드라이브를 사용할 수 없습니다.

사전 요구 사항

- 제품 다운로드 페이지에서 전체 설치 DVD ISO 또는 최소 설치 부팅 ISO 이미지를 다운로드 했습니다.

- ISO 이미지에 충분한 용량이 있는 USB 플래시 드라이브가 있습니다. 필요한 크기는 다르지만 권장 USB 크기는 8GB입니다.

프로세스

- USB플러그 드라이브를 시스템에 연결합니다.

터미널 창을 열고 최근 이벤트 로그를 표시합니다.

dmesg|tail

$ dmesg|tailCopy to Clipboard Copied! Toggle word wrap Toggle overflow 연결된 USB 플래시 드라이브로 인한 메시지가 로그 하단에 표시됩니다. 연결된 장치의 이름을 기록합니다.

root 사용자로 로그인합니다.

su -

$ su -Copy to Clipboard Copied! Toggle word wrap Toggle overflow 메시지가 표시되면 root 암호를 입력합니다.

드라이브에 할당된 장치 노드를 찾습니다. 이 예에서 드라이브 이름은

sdd입니다.Copy to Clipboard Copied! Toggle word wrap Toggle overflow -

삽입된 USB 장치가 자동으로 마운트되는 경우 다음 단계를 계속하기 전에 마운트 해제합니다. 마운트 해제하려면

umount명령을 사용합니다. 자세한 내용은 umount 를 사용하여 파일 시스템 마운트 해제를 참조하십시오. ISO 이미지를 USB 장치에 직접 씁니다.

dd if=/image_directory/image.iso of=/dev/device

# dd if=/image_directory/image.iso of=/dev/deviceCopy to Clipboard Copied! Toggle word wrap Toggle overflow - /image_directory/image.iso 를 다운로드한 ISO 이미지 파일의 전체 경로로 바꿉니다.

장치를 검색한 장치 이름으로

dmesg명령으로 교체합니다.이 예에서 ISO 이미지의 전체 경로는

/home/hiera/Downloads/rhel-8-x86_64-boot.iso이고 장치 이름은sdd입니다.dd if=/home/testuser/Downloads/rhel-8-x86_64-boot.iso of=/dev/sdd

# dd if=/home/testuser/Downloads/rhel-8-x86_64-boot.iso of=/dev/sddCopy to Clipboard Copied! Toggle word wrap Toggle overflow 파티션 이름은 일반적으로 숫자 접미사가 있는 장치 이름입니다. 예를 들어

sdd는 장치 이름이고sdd1은 장치sdd의 파티션 이름입니다.

-

dd명령이 장치에 이미지 쓰기를 마칠 때까지 기다립니다.sync명령을 실행하여 장치에 캐시된 쓰기를 동기화합니다. # 프롬프트가 표시되면 데이터 전송이 완료됩니다. 프롬프트가 표시되면 root 계정에서 로그아웃하고 USB 드라이브를 분리합니다. 이제 USB 드라이브를 부팅 장치로 사용할 준비가 되었습니다.

3.4. Windows에서 부팅 가능한 USB 장치 생성

다양한 도구를 사용하여 Windows 시스템에서 부팅 가능한 USB 장치를 생성할 수 있습니다. https://github.com/FedoraQt/MediaWriter/releases 에서 다운로드할 수 있는 Fedora Media Writer를 사용할 수 있습니다. Fedora Media Writer는 커뮤니티 제품이며 Red Hat에서 지원하지 않습니다. 이 툴의 모든 문제는 https://github.com/FedoraQt/MediaWriter/issues에서 보고할 수 있습니다.

부팅 가능한 드라이브를 생성하면 경고 없이 USB 드라이브의 기존 데이터를 덮어씁니다. 모든 데이터를 백업하거나 빈 플래시 드라이브를 사용합니다. 데이터 저장에는 부팅 가능한 USB 드라이브를 사용할 수 없습니다.

사전 요구 사항

- 제품 다운로드 페이지에서 전체 설치 DVD ISO 또는 최소 설치 부팅 ISO 이미지를 다운로드 했습니다.

- ISO 이미지에 충분한 용량이 있는 USB 플래시 드라이브가 있습니다. 필요한 크기는 다양합니다.

프로세스

- https://github.com/FedoraQt/MediaWriter/releases에서 Fedora Media Writer를 다운로드하여 설치합니다.

- USB플러그 드라이브를 시스템에 연결합니다.

- Fedora Media Writer를 엽니다.

- 메인 창에서 를 클릭하고 이전에 다운로드한 Red Hat Enterprise Linux ISO 이미지를 선택합니다.

- 사용자 지정 이미지 작성 창에서 사용할 드라이브를 선택합니다.

- 를 클릭합니다. 부팅 미디어 생성 프로세스가 시작됩니다. 작업이 완료될 때까지 드라이브를 분리하지 마십시오. 이 작업은 ISO 이미지의 크기와 USB 드라이브의 쓰기 속도에 따라 몇 분이 걸릴 수 있습니다.

- 작업이 완료되면 USB 드라이브를 마운트 해제합니다. USB 드라이브를 부팅 장치로 사용할 준비가 되었습니다.

3.5. macOS에서 부팅 가능한 USB 장치 생성

부팅 가능한 USB 장치를 생성한 다음 다른 시스템에 Red Hat Enterprise Linux를 설치할 수 있습니다. 부팅 가능한 USB 드라이브를 생성하면 경고없이 USB 드라이브에 이전에 저장된 모든 데이터를 덮어씁니다. 모든 데이터를 백업하거나 빈 플래시 드라이브를 사용합니다. 데이터 저장에는 부팅 가능한 USB 드라이브를 사용할 수 없습니다.

사전 요구 사항

- 제품 다운로드 페이지에서 전체 설치 DVD ISO 또는 최소 설치 부팅 ISO 이미지를 다운로드 했습니다.

- ISO 이미지에 충분한 용량이 있는 USB 플래시 드라이브가 있습니다. 필요한 크기는 다양합니다.

프로세스

- USB플러그 드라이브를 시스템에 연결합니다.

diskutil list명령을 사용하여 장치 경로를 식별합니다. 장치 경로의 형식은/dev/disknumber입니다. 여기서number는 디스크 수입니다. 디스크 수가 0(0)에서 시작합니다. 일반적으로disk0은 OS X 복구 디스크이며disk1은 기본 OS X 설치입니다. 다음 예에서 USB 장치는disk2입니다.Copy to Clipboard Copied! Toggle word wrap Toggle overflow - NAME, TYPE 및 SIZE 열을 플래쉬 드라이브와 비교하여 USB 플래시 드라이브를 식별합니다. 예를 들어 NAME은 Finder 도구의 플래시 드라이브 아이콘 제목이어야 합니다. 이러한 값을 플래쉬 드라이브의 정보 패널에 있는 값과 비교할 수도 있습니다.

플래시 드라이브의 파일 시스템 볼륨을 마운트 해제합니다.

diskutil unmountDisk /dev/disknumber Unmount of all volumes on disknumber was successful

$ diskutil unmountDisk /dev/disknumber Unmount of all volumes on disknumber was successfulCopy to Clipboard Copied! Toggle word wrap Toggle overflow 명령이 완료되면 홈 드라이브의 아이콘이 데스크탑에서 사라집니다. 아이콘이 사라지지 않으면 잘못된 디스크를 선택했을 수 있습니다. 시스템 디스크를 실수로 마운트 해제하려고 하면 마운트 해제하지 못했습니다.

플래시 드라이브에 ISO 이미지를 작성합니다. macOS는 각 스토리지 장치에 대해 블록 (

/dev/disk*) 및 문자 장치 (/dev/rdisk*) 파일을 모두 제공합니다./dev/rdisknumber문자 장치에 이미지를 쓰는 것이/dev/disknumber블록 장치에 쓰는 것보다 빠릅니다. 예를 들어/Users/user_name/Downloads/rhel-8-x86_64-boot.iso파일을/dev/rdisk2장치에 작성하려면 다음 명령을 입력합니다.sudo dd if=/Users/user_name/Downloads/rhel-8-x86_64-boot.iso of=/dev/rdisk2 bs=512K status=progress

# sudo dd if=/Users/user_name/Downloads/rhel-8-x86_64-boot.iso of=/dev/rdisk2 bs=512K status=progressCopy to Clipboard Copied! Toggle word wrap Toggle overflow -

if=- 설치 이미지의 경로입니다. -

of=- 대상 디스크를 나타내는 원시 디스크 장치 (/dev/rdisknumber) 입니다. -

BS=512K- 더 빠른 데이터 전송을 위해 블록 크기를 512KB로 설정합니다. -

status=progress- 작업 중 진행률 표시기를 표시합니다.

-

-

dd명령이 장치에 이미지 쓰기를 마칠 때까지 기다립니다. # 프롬프트가 표시되면 데이터 전송이 완료됩니다. 프롬프트가 표시되면 루트 계정에서 로그아웃하고 USB 드라이브를 분리합니다. USB 드라이브를 부팅 장치로 사용할 준비가 되었습니다.

4장. 설치 미디어 부팅

USB 또는 DVD를 사용하여 Red Hat Enterprise Linux 설치를 부팅할 수 있습니다.

Red Hat CDN(Content Delivery Network)을 사용하여 RHEL을 등록할 수 있습니다. CDN은 지리적으로 분산된 웹 서버 시리즈입니다. 이러한 서버는 유효한 서브스크립션을 사용하여 RHEL 호스트에 대한 패키지 및 업데이트를 제공합니다.

설치 중에 CDN에서 RHEL을 등록하고 설치하면 다음과 같은 이점이 있습니다.

- 설치 후 즉시 최신 시스템에 최신 패키지 사용

- Red Hat Insights에 연결하고 시스템 용도를 활성화하기 위한 통합 지원.

RHEL 9.6부터 DISA(DISA) 보안 기술 구현 가이드(STIG) 및 기타 보안 프로필은 최초 부팅 시 연방 정보 처리 표준(FIPS) 모드를 자동으로 활성화하지 않습니다. FIPS 호환 상태를 유지하려면 fips=1 커널 부팅 옵션을 추가하거나 FIPS를 명시적으로 활성화하는 Kickstart 구성을 사용하여 설치가 시작되기 전에 FIPS 모드를 수동으로 활성화해야 합니다. 설치 전에 FIPS를 활성화하지 않으면 이러한 보안 프로필을 사용하여 구축된 시스템이 호환되지 않을 수 있으며 사용자는 호환되지 않는 시스템을 인식하지 못할 수 있습니다. 규정 준수 문제를 방지하려면 그래픽 또는 텍스트 기반 설치 프로그램을 시작하기 전에 부팅 단계에서 FIPS가 활성화되어 있는지 확인합니다.

사전 요구 사항

- 부팅 가능한 설치 미디어( USB 또는 DVD)를 생성했습니다.

프로세스

- Red Hat Enterprise Linux를 설치하는 시스템의 전원을 끕니다.

- 시스템에서 드라이브를 분리합니다.

- 시스템의 전원을 켭니다.

- 부팅 가능한 설치 미디어(USB, DVD 또는 CD)를 삽입합니다.

- 시스템의 전원을 끄지만 부팅 미디어를 제거하지 마십시오.

- 시스템의 전원을 켭니다.

- 미디어에서 부팅하거나 미디어에서 부팅하도록 시스템의BIOS(기본 입력/출력 시스템)를 구성하려면 특정 키 또는 키 조합을 눌러야 할 수 있습니다. 자세한 내용은 시스템과 함께 제공된 설명서를 참조하십시오.

- Red Hat Enterprise Linux 부팅 창이 열리고 다양한 사용 가능한 부팅 옵션에 대한 정보가 표시됩니다.

키보드의 화살표 키를 사용하여 필요한 부팅 옵션을 선택하고 Enter 키를 눌러 부팅 옵션을 선택합니다. welcome to Red Hat Enterprise Linux 창이 열리고 그래픽 사용자 인터페이스를 사용하여 Red Hat Enterprise Linux를 설치할 수 있습니다.

60초 이내에 부팅 창에서 작업이 수행되지 않으면 설치 프로그램이 자동으로 시작됩니다.

선택 사항: 사용 가능한 부팅 옵션을 편집합니다.

- UEFI 기반 시스템: E 를 눌러 편집 모드로 전환합니다. 사전 정의된 명령줄을 변경하여 부팅 옵션을 추가하거나 제거합니다. Enter 를 눌러 선택을 확인합니다.

- BIOS 기반 시스템: 키보드에서 Tab 키를 눌러 편집 모드로 전환합니다. 사전 정의된 명령줄을 변경하여 부팅 옵션을 추가하거나 제거합니다. Enter 를 눌러 선택을 확인합니다.

5장. 선택 사항: 부팅 옵션 사용자 정의

x86_64 또는 ARM64 아키텍처에 RHEL을 설치하는 경우 부팅 옵션을 편집하여 특정 환경에 따라 설치 프로세스를 사용자 지정할 수 있습니다.

5.1. 부팅 옵션

부팅 명령줄에 공백으로 구분된 여러 옵션을 추가할 수 있습니다. 설치 프로그램과 관련된 부팅 옵션은 항상 inst 로 시작합니다. 다음은 사용 가능한 부팅 옵션입니다.

- "=" 기호"가 있는 옵션

-

=기호를 사용하는 부팅 옵션의 값을 지정해야 합니다. 예를 들어inst.vncpassword=옵션에는 값(이 예에서는 암호)이 포함되어야 합니다. 이 예제의 올바른 구문은inst.vncpassword=password입니다. - "=" 기호"가 없는 옵션

-

이 부팅 옵션은 값 또는 매개변수를 허용하지 않습니다. 예를 들어,

rd.live.check옵션은 설치를 시작하기 전에 설치 미디어를 강제로 설치 프로그램에 강제 적용합니다. 이 부팅 옵션이 있는 경우 설치 프로그램이 확인을 수행하고 부팅 옵션이 없으면 확인을 건너뜁니다.

다음과 같은 방법으로 특정 메뉴 항목에 대한 부팅 옵션을 사용자 지정할 수 있습니다.

-

BIOS 기반 시스템에서 다음을 수행합니다.

Tab키를 누른 후 명령줄에 사용자 지정 부팅 옵션을 추가합니다.Esc키를 눌러boot:프롬프트에 액세스할 수도 있지만 필수 부팅 옵션은 사전 설정되어 있지 않습니다. 이 시나리오에서는 다른 부팅 옵션을 사용하기 전에 항상 Linux 옵션을 지정해야 합니다. 자세한 내용은 BIOS에서 boot: 프롬프트 편집을참조하십시오. -

UEFI 기반 시스템에서 다음을 수행합니다.

e키를 누른 후 명령줄에 사용자 지정 부팅 옵션을 추가합니다. 준비가 되면Ctrl+X를 눌러 수정된 옵션을 부팅합니다.

자세한 내용은 UEFI 기반 시스템의 부팅 옵션편집을 참조하십시오.

5.2. BIOS에서 boot: 프롬프트 편집

boot: 프롬프트를 사용하는 경우 첫 번째 옵션은 로드할 설치 프로그램 이미지 파일을 항상 지정해야 합니다. 대부분의 경우 키워드를 사용하여 이미지를 지정할 수 있습니다. 요구 사항에 따라 추가 옵션을 지정할 수 있습니다.

사전 요구 사항

- 부팅 가능한 설치 미디어( USB, CD 또는 DVD)를 생성했습니다.

- 미디어에서 설치를 부팅했으며 설치 부팅 메뉴가 열립니다.

프로세스

- 부팅 메뉴를 열고 키보드의 Esc 키를 누릅니다.

-

이제

boot:프롬프트에 액세스할 수 있습니다. - 키보드에서 Tab 키를 눌러 도움말 명령을 표시합니다.

-

키보드에서 Enter 키를 눌러 옵션으로 설치를 시작합니다.

boot:프롬프트에서 부팅 메뉴로 돌아가려면 시스템을 재시작하고 설치 미디어에서 다시 부팅합니다.

5.3. > 프롬프트를 사용하여 사전 정의된 부팅 옵션 편집

BIOS 기반 AMD64 및 Intel 64 시스템에서는 > 프롬프트를 사용하여 사전 정의된 부팅 옵션을 편집할 수 있습니다.

사전 요구 사항

- 부팅 가능한 설치 미디어( USB, CD 또는 DVD)를 생성했습니다.

- 미디어에서 설치를 부팅했으며 설치 부팅 메뉴가 열립니다.

프로세스

-

부팅 메뉴에서 옵션을 선택하고 키보드의 Tab 키를 누릅니다. &

gt; 프롬프트에 액세스하고 사용 가능한 옵션이 표시됩니다. -

선택 사항: 전체 옵션 세트를 보려면

이 미디어 테스트 를 선택하고 RHEL 8을 설치합니다. 필요한 옵션을

>프롬프트에 추가합니다.예를 들어 연방 정보 처리 표준(FIPS) 140에서 요구하는 암호화 모듈 자체 점검을 활성화하려면

fips=1을 추가합니다.>vmlinuz initrd=initrd.img inst.stage2=hd:LABEL=RHEL-9-5-0-BaseOS-x86_64 rd.live.check quiet fips=1

>vmlinuz initrd=initrd.img inst.stage2=hd:LABEL=RHEL-9-5-0-BaseOS-x86_64 rd.live.check quiet fips=1Copy to Clipboard Copied! Toggle word wrap Toggle overflow - Enter를 눌러 설치를 시작합니다.

- Esc 를 눌러 편집을 취소하고 부팅 메뉴로 돌아갑니다.

5.5. 설치 중 드라이버 업데이트

Red Hat Enterprise Linux 설치 프로세스 중에 드라이버를 업데이트할 수 있습니다. 드라이버를 업데이트하는 것은 완전히 선택 사항입니다. 필요한 경우가 아니면 드라이버 업데이트를 수행하지 마십시오. Red Hat, 하드웨어 벤더 또는 신뢰할 수 있는 타사 벤더가 Red Hat Enterprise Linux 설치 중에 드라이버 업데이트가 필요하다는 알림을 받았습니다.

5.5.1. 개요

Red Hat Enterprise Linux는 많은 하드웨어 장치에 대한 드라이버를 지원하지만 일부 새로 릴리스된 드라이버는 지원되지 않을 수 있습니다. 드라이버 업데이트는 지원되지 않는 드라이버가 설치가 완료되지 않는 경우에만 수행해야 합니다. 일반적으로 설치 중에 드라이버를 업데이트하는 것은 특정 구성을 지원하는 데만 필요합니다. 예를 들어 시스템의 스토리지 장치에 대한 액세스를 제공하는 스토리지 어댑터 카드용 드라이버를 설치합니다.

드라이버 업데이트 디스크에서 충돌하는 커널 드라이버를 비활성화할 수 있습니다. 드문 경우지만 커널 모듈을 언로드하면 설치 오류가 발생할 수 있습니다.

5.5.2. 드라이버 업데이트 유형

Red Hat, 하드웨어 벤더 또는 신뢰할 수 있는 타사는 드라이버 업데이트를 ISO 이미지 파일로 제공합니다. ISO 이미지 파일이 표시되면 드라이버 업데이트 유형을 선택합니다.

드라이버 업데이트 유형

- 자동

-

이 드라이버 업데이트 방법에서

OEMDRV레이블이 지정된 스토리지 장치(CD, DVD 또는 USB 플래시 드라이브 포함)가 시스템에 물리적으로 연결되어 있습니다. 설치가 시작될 때OEMDRV스토리지 장치가 있는 경우 드라이버 업데이트 디스크로 처리되고 설치 프로그램이 해당 드라이버를 자동으로 로드합니다. - 지원됨

-

설치 프로그램에서 드라이버 업데이트를 찾도록 요청합니다.

OEMDRV이외의 레이블과 함께 로컬 스토리지 장치를 사용할 수 있습니다. 설치를 시작할 때inst.dd부팅 옵션이 지정됩니다. 매개 변수 없이 이 옵션을 사용하는 경우 설치 프로그램은 시스템에 연결된 모든 스토리지 장치를 표시하고 드라이버 업데이트가 포함된 장치를 선택하라는 메시지를 표시합니다. - 수동

-

드라이버 업데이트 이미지 또는 RPM 패키지의 경로를 수동으로 지정합니다.

OEMDRV이외의 레이블과 함께 로컬 스토리지 장치 또는 설치 시스템에서 액세스할 수 있는 네트워크 위치를 사용할 수 있습니다.inst.dd=location부팅 옵션은 설치를 시작할 때 지정됩니다. 여기서 location 은 드라이버 업데이트 디스크 또는 ISO 이미지의 경로입니다. 이 옵션을 지정하면 설치 프로그램에서 지정된 위치에 있는 드라이버 업데이트를 로드하려고 합니다. 수동 드라이버 업데이트를 사용하면 로컬 스토리지 장치 또는 네트워크 위치(HTTP, HTTPS 또는 FTP 서버)를 지정할 수 있습니다.inst.dd=location및inst.dd둘 다 동시에 사용할 수 있습니다. 여기서 location은 드라이버 업데이트 디스크 또는 ISO 이미지의 경로입니다. 이 시나리오에서 설치 프로그램은 위치에서 사용 가능한 드라이버 업데이트를 로드하고 드라이버 업데이트가 포함된 장치를 선택하라는 메시지를 표시합니다.

네트워크 위치에서 드라이버 업데이트를 로드할 때 ip= option을 사용하여 네트워크를 초기화합니다.

제한 사항

Secure Boot 기술이 활성화된 UEFI 시스템에서 모든 드라이버에 유효한 인증서로 서명해야 합니다. Red Hat 드라이버는 Red Hat의 개인 키 중 하나에서 서명하고 커널의 해당 공개 키로 인증합니다. 추가 드라이버를 로드하는 경우 해당 드라이버가 서명되었는지 확인합니다.

5.5.3. 드라이버 업데이트 준비

이 절차에서는 CD 및 DVD에서 드라이버 업데이트를 준비하는 방법을 설명합니다.

사전 요구 사항

- Red Hat, 하드웨어 벤더 또는 신뢰할 수 있는 타사 벤더의 드라이버 업데이트 ISO 이미지를 받았습니다.

- 드라이버 업데이트 ISO 이미지를 CD 또는 DVD로 구웠습니다.

.iso로 끝나는 단일 ISO 이미지 파일만 CD 또는 DVD에서 사용할 수 있는 경우, 굽기 프로세스가 성공하지 못했습니다. ISO 이미지를 CD 또는 DVD에 구울 수있는 방법에 대한 지침은 시스템의 소프트웨어 문서를 참조하십시오.

프로세스

- 드라이버 업데이트 CD 또는 DVD를 시스템의 CD/DVD 드라이브에 삽입하고 시스템의 파일 관리자 툴을 사용하여 찾습니다.

-

단일 파일

rhdd3을 사용할 수 있는지 확인합니다.rhdd3은 드라이버 설명과 다양한 아키텍처의 실제 드라이버가 포함된rpms라는 디렉터리가 포함된 서명 파일입니다.

5.5.4. 자동 드라이버 업데이트 수행

다음 절차에서는 설치 중에 자동 드라이버 업데이트를 수행하는 방법을 설명합니다.

사전 요구 사항

-

OEMDRV라벨을 사용하여 표준 디스크 파티션에 드라이버 업데이트 이미지를 배치하거나OEMDRV드라이버를 CD 또는 DVD로 업데이트했습니다. 드라이버 업데이트 프로세스 중에 RAID 또는 LVM 볼륨과 같은 고급 스토리지에 액세스할 수 없습니다. -

OEMDRV볼륨 레이블과 블록 장치를 시스템에 연결하거나 설치 프로세스를 시작하기 전에 준비된 CD 또는 DVD를 시스템의 CD/DVD 드라이브에 삽입했습니다.

프로세스

- 사전 요구 사항 단계를 완료하면 설치 프로그램이 시작될 때 드라이버가 자동으로 로드되고 시스템 설치 프로세스 중에 설치됩니다.

5.5.5. 지원되는 드라이버 업데이트 수행

다음 절차에서는 설치 중에 지원 드라이버 업데이트를 수행하는 방법을 설명합니다.

사전 요구 사항

-

OEMDRV볼륨 레이블이 없는 블록 장치를 시스템에 연결하고 드라이버 디스크 이미지를 이 장치에 복사하거나 드라이버 업데이트 CD 또는 DVD를 준비하여 설치 프로세스를 시작하기 전에 시스템의 CD 또는 DVD 드라이브에 삽입했습니다.

ISO 이미지 파일을 CD 또는 DVD에 구울 수 있지만 OEMDRV 볼륨 레이블이 없는 경우 인수 없이 inst.dd 옵션을 사용할 수 있습니다. 설치 프로그램은 CD 또는 DVD에서 드라이버를 스캔하고 선택할 수 있는 옵션을 제공합니다. 이 시나리오에서는 설치 프로그램에서 드라이버 업데이트 ISO 이미지를 선택하라는 메시지가 표시되지 않습니다. 또 다른 시나리오는 inst.dd=location 부팅 옵션과 함께 CD 또는 DVD를 사용하는 것입니다. 이렇게 하면 설치 프로그램에서 CD 또는 DVD에서 드라이버 업데이트를 자동으로 스캔할 수 있습니다. 자세한 내용은 수동 드라이버 업데이트 수행을 참조하십시오.

프로세스

- 부팅 메뉴 창의 키보드에서 Tab 키를 눌러 부팅 명령줄을 표시합니다.

-

inst.dd부팅 옵션을 명령줄에 추가하고 Enter 키를 눌러 부팅 프로세스를 실행합니다. - 메뉴에서 로컬 디스크 파티션 또는 CD 또는 DVD 장치를 선택합니다. 설치 프로그램은 ISO 파일 또는 드라이버 업데이트 RPM 패키지를 스캔합니다.

선택 사항: 드라이버 업데이트 ISO 파일을 선택합니다.

이 단계는 선택한 장치 또는 파티션에 ISO 이미지 파일이 아닌 드라이버 업데이트 RPM 패키지가 포함된 경우(예: 드라이버 업데이트 CD 또는 DVD가 포함된 광 드라이브)가 필요하지 않습니다.

필요한 드라이버를 선택합니다.

- 키보드의 숫자 키를 사용하여 드라이버 선택을 전환합니다.

- c를 눌러 선택한 드라이버를 설치합니다. 선택한 드라이버가 로드되고 설치 프로세스가 시작됩니다.

5.5.6. 수동 드라이버 업데이트 수행

다음 절차에서는 설치 중에 수동 드라이버 업데이트를 수행하는 방법을 설명합니다.

사전 요구 사항

- 드라이버 업데이트 ISO 이미지 파일을 USB 플래시 드라이브 또는 웹 서버에 배치하고 컴퓨터에 연결했습니다.

프로세스

- 부팅 메뉴 창의 키보드에서 Tab 키를 눌러 부팅 명령줄을 표시합니다.

-

inst.dd=location부트 옵션을 명령줄에 추가합니다. 여기서 location은 드라이버 업데이트의 경로입니다. 일반적으로 이미지 파일은 웹 서버(예: http://server.example.com/dd.iso) 또는 USB 플래시 드라이브(예:/dev/sdb1)에 있습니다. 드라이버 업데이트가 포함된 RPM 패키지를 지정할 수도 있습니다(예: http://server.example.com/dd.rpm). - Enter를 눌러 부팅 프로세스를 실행합니다. 지정된 위치에서 사용할 수 있는 드라이버가 자동으로 로드되고 설치 프로세스가 시작됩니다.

5.5.7. 드라이버 비활성화

다음 절차에서는 오작동 드라이버를 비활성화하는 방법을 설명합니다.

사전 요구 사항

- 설치 프로그램 부팅 메뉴를 부팅했습니다.

프로세스

- 부팅 메뉴에서 키보드의 Tab 키를 눌러 부팅 명령줄을 표시합니다.

modprobe.blacklist=driver_name부팅 옵션을 명령줄에 추가합니다.driver_name을 비활성화하려는 드라이버 또는 드라이버 이름으로 교체합니다. 예를 들면 다음과 같습니다.

modprobe.blacklist=ahci

modprobe.blacklist=ahciCopy to Clipboard Copied! Toggle word wrap Toggle overflow modprobe.blacklist=boot 옵션을 사용하여 비활성화된 드라이버는 설치된 시스템에서 비활성화된 상태로 남아 있으며/etc/modprobe.d/anaconda-blacklist.conf파일에 나타납니다.- Enter를 눌러 부팅 프로세스를 실행합니다.

6장. 설치 프로그램에서 시스템 사용자 정의

설치의 사용자 지정 단계에서 Red Hat Enterprise Linux를 설치할 수 있도록 특정 구성 작업을 수행해야 합니다. 다음과 같은 가상화 작업이 지원됩니다.

- 스토리지를 구성하고 마운트 지점을 할당합니다.

- 소프트웨어를 설치할 기본 환경 선택.

- root 사용자의 암호 설정 또는 로컬 사용자 생성.

선택적으로 시스템 설정을 구성하고 호스트를 네트워크에 연결하여 시스템을 추가로 사용자 지정할 수 있습니다.

6.1. 설치 프로그램 언어 설정

설치를 시작하기 전에 설치 프로그램에서 사용할 언어를 선택할 수 있습니다.

사전 요구 사항

- 설치 미디어가 생성되어 있습니다.

- 부팅 ISO 이미지 파일을 사용하는 경우 설치 소스를 지정했습니다.

- 설치를 부팅했습니다.

프로세스

- 부팅 메뉴에서 Install Red hat Enterprise Linux 옵션을 선택하면 welcome to Red Hat Enterprise Screen 이 표시됩니다.

welcome to Red Hat Enterprise Linux 창 왼쪽 창에서 언어를 선택합니다. 또는 텍스트 상자를 사용하여 선호하는 언어를 검색합니다.

참고언어는 기본적으로 사전 선택됩니다. 네트워크 액세스가 구성된 경우 즉, 로컬 미디어 대신 네트워크 서버에서 부팅한 경우 사전 선택된 언어는 GeoIP 모듈의 자동 위치 탐지 기능에 따라 결정됩니다. 부팅 명령줄 또는 PXE 서버 구성에서

inst.lang=옵션을 사용하는 경우 부팅 옵션으로 정의한 언어가 선택됩니다.- welcome to Red Hat Enterprise Linux 창 오른쪽 창에서 해당 리전과 관련된 위치를 선택합니다.

- 를 클릭하여 그래픽 설치 창을 진행합니다.

Red Hat Enterprise Linux의 시험판 버전을 설치하는 경우 설치 미디어의 시험판 상태에 대한 경고 메시지가 표시됩니다.

- 설치를 계속하려면 계속 , 또는

- 설치를 종료하고 시스템을 재부팅하려면 the installation을 클릭합니다.

6.2. 스토리지 장치 구성

다양한 스토리지 장치에 Red Hat Enterprise Linux를 설치할 수 있습니다. 설치 대상 창에서 로컬로 액세스할 수 있는 기본 스토리지 장치를 구성할 수 있습니다. 디스크 및 솔리드 스테이트 드라이브와 같은 로컬 시스템에 직접 연결된 기본 스토리지 장치는 창의 로컬 표준 디스크 섹션에 표시됩니다. 64비트 IBM Z에서 이 섹션에는 활성화된 DASD(직접 액세스 스토리지 장치)가 포함되어 있습니다.

알려진 문제로 인해 설치가 완료된 후 HyperPAV 별칭으로 구성된 DASD가 자동으로 시스템에 연결되지 않습니다. 이러한 스토리지 장치는 설치 중에 사용할 수 있지만 설치를 완료하고 재부팅한 후에는 즉시 액세스할 수 없습니다. HyperPAV 별칭 장치를 연결하려면 시스템의 /etc/dasd.conf 구성 파일에 수동으로 추가합니다.

6.2.1. 설치 대상 구성

Installation Destination 창을 사용하여 스토리지 옵션(예: Red Hat Enterprise Linux 설치의 설치 대상으로 사용할 디스크)을 구성할 수 있습니다. 디스크를 하나 이상 선택해야 합니다.

사전 요구 사항

- Installation Summary 창이 열립니다.

- 이미 데이터가 포함된 디스크를 사용하려는 경우 데이터를 백업해야 합니다. 예를 들어 기존 Microsoft Windows 파티션을 축소하고 Red Hat Enterprise Linux를 두 번째 시스템으로 설치하거나 이전 Red Hat Enterprise Linux 릴리스를 업그레이드하는 경우. 파티션을 조작하는 것은 항상 위험이 있습니다. 예를 들어 디스크의 어떤 이유로든 프로세스가 중단되거나 실패하는 경우 해당 프로세스가 손실될 수 있습니다.

프로세스

Installation Summary 창에서 Installation Destination 을 클릭합니다. 설치 대상 창에서 다음 작업을 수행합니다.

로컬 표준 디스크 섹션에서 필요한 스토리지 장치를 선택합니다. 흰색 확인 표시는 선택을 나타냅니다. 설치 프로세스 중에 흰색 확인 표시가 없는 디스크는 사용되지 않습니다. 자동 파티션을 선택하면 무시되며 수동 파티션에서 사용할 수 없습니다.

로컬 표준 디스크 는 SATA, IDE 및 SCSI 디스크, USB 플래시 및 외부 디스크와 같이 로컬에서 사용 가능한 모든 스토리지 장치를 표시합니다. 설치 프로그램이 시작된 후 연결된 스토리지 장치가 감지되지 않습니다. 이동식 드라이브를 사용하여 Red Hat Enterprise Linux를 설치하는 경우 장치를 제거하면 시스템을 사용할 수 없습니다.

선택 사항: 새 디스크를 연결하도록 추가 로컬 스토리지 장치를 구성하려면 창의 오른쪽 아래에 있는 새로 고침 링크를 클릭합니다. Rescan Disks 대화 상자가 열립니다.

를 클릭하고 스캔 프로세스가 완료될 때까지 기다립니다.

설치 중에 수행한 모든 스토리지 변경 사항은 Rescan Disks 를 클릭하면 손실됩니다.

- 클릭하여 설치 대상 창으로 돌아갑니다. 새 디스크를 포함하여 감지된 모든 디스크가 로컬 표준 디스크 섹션에 표시됩니다.

선택 사항: 클릭하여 특수 스토리지 장치를 추가합니다.

스토리지 장치 선택 창이 열리고 설치 프로그램에서 액세스할 수 있는 모든 스토리지 장치가 나열됩니다.

선택 사항: 스토리지 구성에서 자동 파티셔닝을 위한 자동 라디오 버튼을 선택합니다.

사용자 지정 파티셔닝을 구성할 수도 있습니다. 자세한 내용은 수동 파티션 구성을 참조하십시오.

- 선택 사항: 기존 파티션 레이아웃에서 공간을 회수하기 위해 추가 공간을 확보하려면 I would like to make additional space available to reclaim space from an existing partitioning layout을 선택합니다. 예를 들어 사용하려는 디스크에 이미 다른 운영 체제가 있고 이 시스템의 파티션을 줄여 Red Hat Enterprise Linux에 더 많은 공간을 허용하려는 경우입니다.

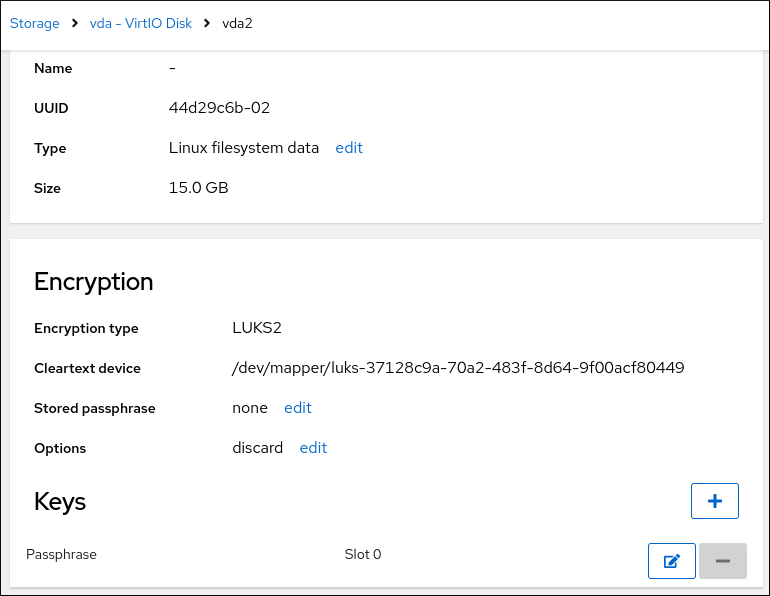

선택 사항: LUKS( Linux Unified Key Setup )를 사용하여 시스템을 부팅하는 데 필요한 파티션(예:

/boot)을 제외한 모든 파티션을 암호화하려면 데이터 암호화를 선택합니다. 디스크를 암호화하여 추가 보안 계층을 추가합니다.을 클릭합니다. 디스크 암호화 암호 대화 상자가 열립니다.

- 암호를 암호 및 확인 필드에 입력합니다.

를 클릭하여 디스크 암호화를 완료합니다.

주의LUKS 암호를 분실하는 경우 암호화된 파티션과 해당 데이터에 완전히 액세스할 수 없습니다. 분실된 암호를 복구할 방법은 없습니다. 그러나 Kickstart 설치를 수행하는 경우 암호화 암호를 저장하고 설치 중에 백업 암호화 암호를 생성할 수 있습니다. 자세한 내용은 RHEL 자동 설치 문서를 참조하십시오.

선택 사항: 창의 왼쪽 아래에 있는 전체 디스크 요약 및 부트로더 링크를 클릭하여 부트 로더가 포함된 스토리지 장치를 선택합니다. 자세한 내용은 부트 로더 구성을 참조하십시오.

대부분의 경우 부트 로더를 기본 위치에 두면 충분합니다. 예를 들어 다른 부트 로더에서 체인 로드가 필요한 일부 구성에서는 부팅 드라이브를 수동으로 지정해야 합니다.

- 을 클릭합니다.

선택 사항: 자동 파티셔닝 을 선택하고 추가 공간을 제공하려는 경우 또는 Red Hat Enterprise Linux를 설치하기 위해 선택한 디스크에 여유 공간이 충분하지 않은 경우 Reclaim Disk Space (디스크 공간 회수) 대화 상자가 표시됩니다. 구성된 모든 디스크 장치 및 해당 장치의 모든 파티션을 나열합니다. 대화 상자에는 현재 선택한 패키지 세트와 회수된 공간이 있는 설치에 필요한 최소 디스크 공간에 대한 정보가 표시됩니다. 회수 프로세스를 시작하려면 다음을 수행합니다.

- 사용 가능한 스토리지 장치의 표시된 목록을 검토합니다. Reclaimable Space 열에는 각 항목에서 회수할 수 있는 공간이 표시됩니다.

- 공간을 회수할 디스크 또는 파티션을 선택합니다.

- 버튼을 사용하여 기존 데이터를 유지하면서 파티션에서 사용 가능한 공간을 사용합니다.

- 버튼을 사용하여 기존 데이터를 포함하여 선택한 디스크의 파티션 또는 모든 파티션을 삭제합니다.

- 버튼을 사용하여 기존 데이터를 포함한 모든 디스크의 기존 파티션을 모두 삭제하고 Red Hat Enterprise Linux를 설치하는 데 이 공간을 사용할 수 있도록 합니다.

를 클릭하여 변경 사항을 적용하고 그래픽 설치로 돌아갑니다.

설치 요약 창에서 시작을 클릭할 때까지 디스크 변경이 수행되지 않습니다. 공간 회수 대화 상자는 크기 조정 또는 삭제를 위한 파티션만 표시합니다. 작업이 수행되지 않습니다.

6.2.2. 설치 대상 구성 중 특수 사례

다음은 설치 대상을 구성할 때 고려해야 할 몇 가지 특수한 사례입니다.

-

일부 BIOS 유형은 RAID 카드 부팅을 지원하지 않습니다. 이러한 경우

/boot파티션을 별도의 디스크와 같이 RAID 배열 외부의 파티션에 만들어야 합니다. RAID 카드가 문제가 있는 파티션 생성을 위해 내부 디스크를 사용해야 합니다. 소프트웨어 RAID 설정에도/boot파티션이 필요합니다. 시스템을 자동으로 파티션하도록 선택하는 경우/boot파티션을 수동으로 편집해야 합니다. - 다른 부트 로더의 부하를 체인 하도록 Red Hat Enterprise Linux 부트 로더를 구성하려면 Installation Destination 창에서 전체 디스크 요약 및 부트로더 링크를 클릭하여 수동으로 부팅 드라이브를 지정해야 합니다.

- 다중 경로 및 비 다중 경로 스토리지 장치가 모두 있는 시스템에 Red Hat Enterprise Linux를 설치하면 설치 프로그램의 자동 파티션 레이아웃은 다중 경로 및 비 멀티패스 장치가 포함된 볼륨 그룹을 생성합니다. 이로 인해 다중 경로 스토리지의 목적을 지웁니다. Installation Destination 창에서 multipath 또는 non-multipath 장치를 선택합니다. 또는 수동 파티셔닝을 진행합니다.

6.2.3. 부트 로더 구성

Red Hat Enterprise Linux는 AMD64 및 Intel 64, IBM Power Systems 및 ARM의 부트 로더로 GRand Unified Bootloader 버전 2(GRUB2)를 사용합니다. 64비트 IBM Z의 경우 zipl 부트 로더가 사용됩니다.

부트 로더는 시스템이 시작될 때 실행되고 컨트롤을 운영 체제로 로드 및 전송하는 역할을 하는 첫 번째 프로그램입니다. GRUB2 는 호환 가능한 운영 체제(Microsoft Windows 포함)를 부팅할 수 있으며 체인 로드를 사용하여 지원되지 않는 운영 체제의 다른 부트 로더로 제어를 전송할 수도 있습니다.

GRUB2 를 설치하면 기존 부트 로더를 덮어쓸 수 있습니다.

운영 체제가 이미 설치된 경우 Red Hat Enterprise Linux 설치 프로그램은 다른 운영 체제를 시작하도록 부트 로더를 자동으로 감지하고 구성하려고 합니다. 부트 로더가 탐지되지 않으면 설치를 완료한 후 추가 운영 체제를 수동으로 구성할 수 있습니다.

두 개 이상의 디스크가 있는 Red Hat Enterprise Linux 시스템을 설치하는 경우 부트 로더를 설치하려는 디스크를 수동으로 지정할 수 있습니다.

절차

Installation Destination 창에서 전체 디스크 요약 및 부트로더 링크를 클릭합니다. 선택한 디스크 대화 상자가 열립니다.

부트 로더는 선택한 장치 또는 UEFI 시스템에 설치됩니다. EFI 시스템 파티션이 안내된 파티션 중에 대상 장치에 생성됩니다.

- 부팅 장치를 변경하려면 목록에서 장치를 선택하고 를 클릭합니다. 하나의 장치만 부팅 장치로 설정할 수 있습니다.

- 새 부트 로더 설치를 비활성화하려면 현재 부팅용으로 표시된 장치를 선택하고 를 클릭합니다. 이렇게 하면 GRUB2 가 어떤 장치에도 설치되지 않습니다.

부트 로더를 설치하지 않도록 선택하는 경우 시스템을 직접 부팅할 수 없으며 독립 실행형 상용 부트 로더 애플리케이션과 같은 다른 부팅 방법을 사용해야 합니다. 시스템을 부팅하는 다른 방법이 있는 경우에만 이 옵션을 사용합니다.

또한 부트 로더는 시스템이 BIOS 또는 UEFI 펌웨어를 사용하는지 또는 부팅 드라이브에 GUID 파티션 테이블 (GPT) 또는 마스터 부팅 레코드 (MBR) 레이블이 있는지에 따라 특수 파티션을 생성해야 할 수도 있습니다. 자동 파티션을 사용하는 경우 설치 프로그램이 파티션을 생성합니다.

6.2.4. 스토리지 장치 선택

스토리지 장치 선택 창에는 설치 프로그램이 액세스할 수 있는 모든 스토리지 장치가 나열됩니다. 시스템 및 사용 가능한 하드웨어에 따라 일부 탭이 표시되지 않을 수 있습니다. 장치는 다음 탭 아래에 그룹화됩니다.

- 다중 경로 장치

- 동일한 시스템의 여러 SCSI 컨트롤러 또는 파이버 채널 포트를 통해 두 개 이상의 경로를 통해 액세스할 수 있는 스토리지 장치입니다. 설치 프로그램은 일련 번호가 16 또는 32자인 다중 경로 스토리지 장치만 감지합니다.

- 기타 SAN 장치

- SAN(Storage Area Network)에서 사용 가능한 장치.

- 펌웨어 RAID

- 펌웨어 RAID 컨트롤러에 연결된 스토리지 장치입니다.

- NVDIMM 장치

- 특정 상황에서 Red Hat Enterprise Linux 8은 Intel 64 및 AMD64 아키텍처의 섹터 모드에서 (NVDIMM) 장치에서 부팅 및 실행할 수 있습니다.

- IBM Z 장치

- 스토리지 장치 또는 논리 단위(LUN)는 zSeries Linux FCP(Fiber Channel Protocol) 드라이버를 통해 연결된 DASD입니다.

6.2.5. 스토리지 장치 필터링

스토리지 장치 선택 창에서 WWID(World Wide Identifier) 또는 포트, 대상 또는 LUN(Logical Unit Number)을 통해 스토리지 장치를 필터링할 수 있습니다.

사전 요구 사항

- Installation Summary 창이 열립니다.

절차

- Installation Summary 창에서 Installation Destination 을 클릭합니다. 설치 대상 창이 열리고 사용 가능한 모든 드라이브가 나열됩니다.

- Specialized & Network Disks 섹션에서 클릭합니다. 스토리지 장치 선택 창이 열립니다.

포트, 대상, LUN 또는 WWID로 검색하려면 검색 기준 탭을 클릭합니다.

WWID 또는 LUN으로 검색하려면 해당 입력 텍스트 필드에 추가 값이 필요합니다.

- 검색 드롭다운 메뉴에서 필요한 옵션을 선택합니다.

- 클릭하여 검색을 시작합니다. 각 장치는 해당 확인란이 있는 별도의 행에 표시됩니다.

설치 프로세스 중에 필요한 장치를 활성화하려면 확인란을 선택합니다.

나중에 설치 과정에서 선택한 장치에 Red Hat Enterprise Linux를 설치하도록 선택할 수 있으며, 설치된 시스템의 일부로 선택한 다른 장치를 자동으로 마운트하도록 선택할 수 있습니다. 선택한 장치는 설치 프로세스에서 자동으로 삭제되지 않으며 장치를 선택하면 장치에 저장된 데이터가 위험하지 않습니다.

참고/etc/fstab파일을 수정하여 설치 후 시스템에 장치를 추가할 수 있습니다.- 을 클릭하여 Installation Destination 창으로 돌아갑니다.

선택하지 않은 스토리지 장치는 설치 프로그램에서 완전히 숨겨집니다. 체인이 다른 부트 로더에서 부트 로더를 로드하려면 존재하는 모든 장치를 선택합니다.

6.2.6. 고급 스토리지 옵션 사용

고급 스토리지 장치를 사용하려면 iSCSI(TCP/IP를 통한 iSCSI) 대상 또는 FCoE(Fibre Channel over Ethernet) SAN(Storage Area Network)을 구성할 수 있습니다.

설치에 iSCSI 스토리지 장치를 사용하려면 설치 프로그램에서 iSCSI 대상으로 검색하고 iSCSI 세션을 생성하여 액세스할 수 있어야 합니다. 이러한 각 단계에는 CHP(Chalge Handshake Authentication Protocol) 인증을 위한 사용자 이름과 암호가 필요할 수 있습니다. 또한 검색 및 세션에 대해 대상이 연결된 시스템에서 iSCSI 이니시에이터를 인증하도록 iSCSI 대상을 구성할 수 있습니다. 함께 사용되는 CHAP 및 역방향 CHAP는 상호 CHAP 또는 양방향 CHAP라고 합니다. 상호 CHAP는 특히 사용자 이름과 암호가 CHAP 인증 및 역방향 CHAP 인증에 대해 다른 경우 iSCSI 연결에 가장 큰 수준의 보안을 제공합니다.

iSCSI 검색 및 iSCSI 로그인 단계를 반복하여 필요한 모든 iSCSI 스토리지를 추가합니다. 처음으로 검색을 시도한 후에는 iSCSI 이니시에이터의 이름을 변경할 수 없습니다. iSCSI 이니시에이터 이름을 변경하려면 설치를 다시 시작해야 합니다.

6.2.6.1. iSCSI 세션 검색 및 시작

Red Hat Enterprise Linux 설치 프로그램은 다음 두 가지 방법으로 iSCSI 디스크를 검색하고 로그인할 수 있습니다.

- iSCSI 부팅 펌웨어 테이블(iBFT)

-

설치 프로그램이 시작되면 시스템의 BIOS 또는 애드온 부팅 1)이 iBFT를 지원하는지 확인합니다. iSCSI에서 부팅할 수 있는 시스템용 BIOS 확장입니다. BIOS가 iBFT를 지원하는 경우 설치 프로그램은 BIOS에서 구성된 부팅 디스크에 대한 iSCSI 대상 정보를 읽고 이 대상에 로그인하여 설치 대상으로 사용할 수 있도록 합니다. iSCSI 대상에 자동으로 연결하려면 대상에 액세스하기 위해 네트워크 장치를 활성화합니다. 이렇게 하려면

ip=ibft부팅 옵션을 사용합니다. 자세한 내용은 네트워크 부팅 옵션을 참조하십시오. - iSCSI 대상 검색 및 수동 추가

- iSCSI 세션을 검색하고 시작하여 설치 프로그램의 그래픽 사용자 인터페이스에서 사용 가능한 iSCSI 대상(네트워크 스토리지 장치)을 확인할 수 있습니다.

사전 요구 사항

- Installation Summary 창이 열립니다.

절차

- Installation Summary 창에서 Installation Destination 을 클릭합니다. 설치 대상 창이 열리고 사용 가능한 모든 드라이브가 나열됩니다.

- Specialized & Network Disks 섹션에서 클릭합니다. 스토리지 장치 선택 창이 열립니다.

클릭합니다. iSCSI 스토리지 대상 추가 창이 열립니다.

중요이 방법을 사용하여 수동으로 추가한 iSCSI 대상에

/boot파티션을 배치할 수 없습니다. iBFT와 함께 사용하도록/boot파티션이 포함된 iSCSI 대상을 구성해야 합니다. 그러나 설치된 시스템이 펌웨어 iBFT 이외의 방법으로 제공되는 iBFT 구성으로 iSCSI에서 부팅해야 하는 경우 예를 들어 iPXE를 사용하는 경우inst.nonibftiscsiboot설치 프로그램 부팅 옵션을 사용하여/boot파티션 제한을 제거할 수 있습니다.- 대상 IP 주소 필드에 iSCSI 대상의 IP 주소를 입력합니다.

iSCSI 정규화된 이름 (IQN) 형식의 iSCSI 이니시에이터의 iSCSI 초기자 이름 필드에 이름을 입력합니다. 유효한 IQN 항목에는 다음 정보가 포함됩니다.

-

문자열

iqn(시간 참조). -

조직의 인터넷 도메인 또는 하위 도메인 이름이 등록된 연도 및 월을 지정하는 날짜 코드는 연도, 대시, 한 달의 4 자리 숫자와 마침표로 표시됩니다. 예를 들어 2010년 9월은

2010-09로 표시됩니다. -

조직의 인터넷 도메인 또는 하위 도메인 이름이 먼저 최상위 도메인과 역순으로 표시됩니다. 예를 들어, 하위 도메인

storage.example.com을com.example.storage로 나타냅니다. 콜론 뒤에는 도메인 또는 하위 도메인 내에서 이 특정 iSCSI 이니시에이터를 고유하게 식별하는 문자열이 옵니다. 예:

:diskarrays-sn-a8675309.완전한 IQN은

iqn.2010-09.storage.example.com:diskarrays-sn-a8675309. 설치 프로그램은iSCSI Initiator Name필드를 이 형식의 이름으로 미리 채워 구조를 지원합니다. IQN에 대한 자세한 내용은 tools.ietf .org 및 1에서 제공되는 RFC 3720 - iSCSI(Internet Small Computer Systems Interface) 의 3.2.6. iSCSI 이름을 참조하십시오. tools.ietf.org에서 사용할 수 있는 RFC 3721 - iSCSI(Internet Small Computer Systems Interface) 이름 지정 및 검색에서 사용할 수 있습니다.

-

문자열

Discovery Authentication Type드롭다운 메뉴를 선택하여 iSCSI 검색에 사용할 인증 유형을 지정합니다. 다음 옵션을 사용할 수 있습니다.- 인증 정보 없음

- CHAP 쌍

- CHAP 쌍 및 역방향 쌍

다음 중 하나를 수행합니다.

-

CHAP 쌍을인증 유형으로 선택한 경우 CHAP 사용자 이름 및CHAP 암호필드에 iSCSI 대상의 사용자 이름 -

CHAP 쌍과 역방향 쌍을인증 유형으로 선택한 경우 CHAP 사용자 이름 및 CHAP 암호 필드에 iSCSI 대상의 사용자 이름과 암호를 입력하고 ReverseCHAPUsernameReverseAP이름과 암호를 입력합니다.Password필드에 iSCSI 이니시에이터의 사용자

-

-

선택 사항:

Bind targets to network interfaces확인란을 선택합니다. 클릭합니다.

설치 프로그램은 제공된 정보를 기반으로 iSCSI 대상을 검색하려고 합니다. 검색에 성공하면

iSCSI 스토리지 대상 추가 창에 대상에서 검색된 모든 iSCSI 노드 목록이 표시됩니다.설치에 사용할 노드의 확인란을 선택합니다.

Node login authentication type메뉴에는Discovery Authentication Type메뉴와 동일한 옵션이 포함되어 있습니다. 그러나 검색 인증에 대한 인증 정보가 필요한 경우 동일한 인증 정보를 사용하여 검색된 노드에 로그인합니다.-

검색 드롭다운 메뉴에서 추가

Use the credentials from discovery를 클릭합니다. 적절한 인증 정보를 제공하면 버튼을 사용할 수 있게 됩니다. - 을 클릭하여 iSCSI 세션을 시작합니다.

설치 프로그램은 iscsiadm 을 사용하여 iSCSI 대상을 찾아 로그인하는 반면 iscsiadm 은 iscsiadm iSCSI 데이터베이스에 이러한 대상에 대한 모든 정보를 자동으로 저장합니다. 그런 다음 설치 프로그램이 이 데이터베이스를 설치된 시스템에 복사하고 루트 파티션에 사용되지 않는 iSCSI 대상을 표시하여 시스템이 시작될 때 자동으로 로그인하도록 합니다. 루트 파티션이 iSCSI 대상에 배치된 경우 initrd 는 이 대상에 로그하고 설치 프로그램은 동일한 대상에 여러 번 로그인하려고 시도하지 않도록 시작 스크립트에 이 대상을 포함하지 않습니다.

6.2.6.2. FCoE 매개변수 구성

FCoE 매개변수를 구성하여 설치 대상 창에서 FCoE(Fibre Channel over Ethernet) 장치를 검색할 수 있습니다.

사전 요구 사항

- Installation Summary 창이 열립니다.

절차

- Installation Summary 창에서 Installation Destination 을 클릭합니다. 설치 대상 창이 열리고 사용 가능한 모든 드라이브가 나열됩니다.

- Specialized & Network Disks 섹션에서 클릭합니다. 스토리지 장치 선택 창이 열립니다.

- 클릭합니다. FCoE 스토리지 장치를 검색하기 위해 네트워크 인터페이스를 구성할 수 있는 대화 상자가 열립니다.

-

NIC드롭다운 메뉴에서 FCoE 스위치에 연결된 네트워크 인터페이스를 선택합니다. - 를 클릭하여 SAN 장치의 네트워크를 스캔합니다.

필요한 확인란을 선택합니다.

- DCB 사용:DCB(Data Center Bridging )는 스토리지 네트워크 및 클러스터에서 이더넷 연결의 효율성을 높이기 위해 설계된 이더넷 프로토콜의 개선 사항 세트입니다. DCB에 대한 설치 프로그램의 인식을 활성화하거나 비활성화하려면 확인란을 선택합니다. 호스트 기반 DCBX 클라이언트가 필요한 네트워크 인터페이스에만 이 옵션을 활성화합니다. 하드웨어 DCBX 클라이언트를 사용하는 인터페이스의 구성의 경우 확인란을 비활성화합니다.

- 자동 vlan:자동 VLAN 은 기본적으로 활성화되어 있으며 VLAN 검색을 수행해야 하는지 여부를 나타냅니다. 이 확인란이 활성화되면 FIP(FCoE Initiation Protocol) VLAN 검색 프로토콜이 링크 구성을 검증할 때 이더넷 인터페이스에서 실행됩니다. 아직 구성되지 않은 경우 검색된 FCoE VLAN에 대한 네트워크 인터페이스가 자동으로 생성되고 VLAN 인터페이스에 FCoE 인스턴스가 생성됩니다.

-

검색된 FCoE 장치는 설치 대상 창의

기타 SAN 장치탭에 표시됩니다.

6.2.6.3. DASD 스토리지 장치 구성

설치 대상 창에서 DASD 스토리지 장치를 검색하고 구성할 수 있습니다.

사전 요구 사항

- Installation Summary 창이 열립니다.

절차

- Installation Summary 창에서 Installation Destination 을 클릭합니다. 설치 대상 창이 열리고 사용 가능한 모든 드라이브가 나열됩니다.

- Specialized & Network Disks 섹션에서 클릭합니다. 스토리지 장치 선택 창이 열립니다.

- 클릭합니다. DASD 스토리지 대상 추가 대화 상자가 열리고 0.0.0204 와 같은 장치 번호를 지정하고 설치를 시작할 때 감지되지 않은 추가 DASD를 연결하라는 메시지를 표시합니다.

- 장치 번호 필드에 연결할 DASD의 장치 번호를 입력합니다.

클릭합니다.

지정된 장치 번호가 있는 DASD가 발견되고 아직 연결되지 않은 경우 대화 상자가 닫히고 새로 발견된 드라이브가 드라이브 목록에 표시됩니다. 그런 다음 필요한 장치에 대한 확인란을 선택하고 를 클릭합니다. 새로운 DASD를 선택할 수 있으며, 설치 대상 창의 로컬 표준 디스크 섹션에서

DASD 장치 0.0.xxxx로 표시됩니다.

잘못된 장치 번호를 입력하거나 지정된 장치 번호가 있는 DASD가 이미 시스템에 연결된 경우 오류 상자에 오류 메시지가 표시되고 다른 장치 번호로 다시 시도하라는 메시지가 표시됩니다.

6.2.6.4. FCP 장치 구성

FCP 장치를 사용하면 64비트 IBM Z에서 직접 액세스 스토리지 장치(DASD) 장치 대신 또는 SCSI 장치를 사용할 수 있습니다. FCP 장치는 64비트 IBM Z 시스템이 기존 DASD 장치 외에도 디스크 장치로 SCSI LUN을 사용할 수 있는 전환 패브릭 토폴로지를 제공합니다.

사전 요구 사항

- Installation Summary 창이 열립니다.

-

FCP 전용 설치의 경우 CMS 구성 파일 또는

rd.dasd=옵션에서DASD=옵션을 제거하여 DASD가 없음을 나타냅니다.

절차

- Installation Summary 창에서 Installation Destination 을 클릭합니다. 설치 대상 창이 열리고 사용 가능한 모든 드라이브가 나열됩니다.

- Specialized & Network Disks 섹션에서 클릭합니다. 스토리지 장치 선택 창이 열립니다.

클릭합니다. FCP(Fibre Channel Protocol) 스토리지 장치를 추가할 수 있도록 zFCP 스토리지 대상 추가 대화 상자가 열립니다.

64비트 IBM Z를 사용하려면 설치 프로그램이 FCP LUN을 활성화할 수 있도록 FCP 장치를 수동으로 입력해야 합니다. 그래픽 설치에서 FCP 장치를 입력하거나 매개 변수 또는 CMS 구성 파일에서 고유한 매개 변수 항목으로 입력할 수 있습니다. 입력한 값은 구성하는 각 사이트에 고유해야 합니다.

- 장치 번호 필드에 4 자리 16진수 장치 번호를 입력합니다.

RHEL-8.6 또는 이전 릴리스를 설치하거나

zFCP장치가 NPIV 모드에서 구성되지 않은 경우 또는zfcp.allow_lun_scan=0커널 모듈 매개변수에 의해자동 LUN스캔을 비활성화하면 다음 값을 제공합니다.- WWPN 필드에 16 자리 16진수 WWPN(World Wide Port Number)을 입력합니다.

- LUN 필드에 16 자리 16진수 FCP LUN 식별자를 입력합니다.

- 클릭하여 FCP 장치에 연결합니다.

새로 추가된 장치는 설치 대상 창의 IBM Z 탭에 표시됩니다.

16진수 값에서 소문자만 사용합니다. 잘못된 값을 입력하고 클릭하면 설치 프로그램에 경고가 표시됩니다. 구성 정보를 편집하고 검색 시도를 다시 시도할 수 있습니다. 이러한 값에 대한 자세한 내용은 하드웨어 설명서를 참조하고 시스템 관리자에게 확인하십시오.

6.2.7. NVDIMM 장치에 설치

non-Volatile Dual In-line Memory Module (NVDIMM) 장치는 전원이 공급되지 않을 때 RAM의 성능을 디스크와 같은 데이터 지속성과 결합합니다. 특정 상황에서 Red Hat Enterprise Linux 8은 NVDIMM 장치에서 부팅 및 실행할 수 있습니다.

6.2.7.1. NVDIMM 장치를 설치 대상으로 사용하기 위한 기준

Intel 64 및 AMD64 아키텍처의 섹터 모드에서 nd_pmem 드라이버에서 지원하는 NVDIMM(Non-Volatile Dual In-line Memory Module) 장치에 Red Hat Enterprise Linux 8을 설치할 수 있습니다.

NVDIMM 장치를 스토리지로 사용하기 위한 조건

NVDIMM 장치를 스토리지로 사용하려면 다음 조건을 충족해야 합니다.

- 시스템의 아키텍처는 Intel 64 또는 AMD64입니다.

- NVDIMM 장치는 섹터 모드로 구성됩니다. 설치 프로그램은 NVDIMM 장치를 이 모드로 재구성할 수 있습니다.

- NVDIMM 장치는 nd_pmem 드라이버에서 지원해야 합니다.

NVDIMM 장치에서 부팅하는 조건

다음과 같은 조건에서 NVDIMM 장치에서 부팅할 수 있습니다.

- 스토리지로 NVDIMM 장치를 사용하기 위한 모든 조건이 충족됩니다.

- 시스템은 UEFI를 사용합니다.

- NVDIMM 장치는 시스템에서 사용 가능한 펌웨어 또는 UEFI 드라이버에서 지원해야 합니다. UEFI 드라이버는 장치 자체의 옵션rom에서 로드될 수 있습니다.

- NVDIMM 장치는 네임스페이스에서 사용할 수 있어야 합니다.

부팅 중에 NVDIMM 장치의 고성능을 활용하고 장치에 /boot 및 /boot/efi 디렉토리를 배치합니다. NVDIMM 장치의 Execute-in-place (XIP) 기능은 부팅 중에 지원되지 않으며 커널은 기존 메모리에 로드됩니다.

6.2.7.2. 그래픽 설치 모드를 사용하여 NVDIMM 장치 구성

Red Hat Enterprise Linux 8에서 그래픽 설치를 사용하도록 NVMe(Non-Volatile Dual In-line Memory Module) 장치를 올바르게 구성해야 합니다.

NVDIMM 장치 프로세스를 재구성하면 장치에 저장된 모든 데이터가 제거됩니다.

사전 요구 사항

- NVDIMM 장치가 시스템에 존재하며 다른 모든 사용 조건을 설치 대상으로 충족합니다.

- 설치가 부팅되고 설치 요약 창이 열립니다.

절차

- Installation Summary 창에서 Installation Destination 을 클릭합니다. 설치 대상 창이 열리고 사용 가능한 모든 드라이브가 나열됩니다.

- Specialized & Network Disks 섹션에서 클릭합니다. 스토리지 장치 선택 창이 열립니다.

- NVDIMM 장치 탭을 클릭합니다.

장치를 재구성하려면 목록에서 해당 장치를 선택합니다.

장치가 나열되지 않은 경우 섹터 모드에 있지 않습니다.

- 클릭합니다. 재구성 대화 상자가 열립니다.

필요한 섹터 크기를 입력하고 클릭합니다.

지원되는 섹터 크기는 512 및 4096바이트입니다.

- 재구성이 완료되면 를 클릭합니다.

- 장치 확인란을 선택합니다.

을 클릭하여 Installation Destination 창으로 돌아갑니다.

재구성한 NVDIMM 장치는 Specialized & Network Disks 섹션에 표시됩니다.

- 을 클릭하여 Installation Summary 창으로 돌아갑니다.

이제 설치 대상으로 선택할 수 있는 NVDIMM 장치를 사용할 수 있습니다. 또한 장치가 부팅 요구 사항을 충족하는 경우 장치를 부팅 장치로 설정할 수 있습니다.

6.3. root 사용자 구성 및 로컬 계정 생성

6.3.1. root 암호 구성

설치 프로세스를 완료하고 시스템 관리 작업에 사용되는 관리자(슈퍼유저 또는 root ) 계정에 로그인하도록 루트 암호를 구성해야 합니다. 이러한 작업에는 소프트웨어 패키지 설치 및 업데이트, 네트워크 및 방화벽 설정, 스토리지 옵션, 사용자, 그룹 및 파일 권한 추가 또는 수정과 같은 시스템 전체 구성 변경이 포함됩니다.

설치된 시스템에 대한 root 권한을 얻으려면 root 계정을 사용하거나 관리 권한이 있는 사용자 계정을 만듭니다( wheel 그룹의 구성원). root 계정은 설치 중에 항상 생성됩니다. 관리자 액세스 권한이 필요한 작업을 수행해야 하는 경우에만 관리자 계정으로 전환합니다.

root 계정은 시스템을 완전히 제어할 수 있습니다. 권한이 없는 사용자가 계정에 액세스할 수 있는 경우 사용자의 개인 파일에 액세스하거나 삭제할 수 있습니다.

절차

- 설치 요약 창에서 사용자 설정 > 루트 암호를 선택합니다. Root Password 창이 열립니다.

Root Password 필드에 암호를 입력합니다.

강력한 root 암호를 생성하기 위한 요구 사항은 다음과 같습니다.

- 길이가 8자 이상이어야 합니다.

- 숫자, 문자 (upper and lower case) 및 기호를 포함할 수 있습니다.

- 대소문자를 구분합니다.

- Confirm 필드에 동일한 암호를 입력합니다.

을 클릭하여 root 암호를 확인하고 Installation Summary 창으로 돌아갑니다.

약한 암호를 사용하는 경우 를 두 번 클릭해야 합니다.

6.3.2. 사용자 계정 생성

설치를 완료하기 위해 사용자 계정을 생성합니다. 사용자 계정을 생성하지 않으면 root 로 시스템에 직접 로그인해야 합니다. 이 방법은 권장되지 않습니다.

절차

- 설치 요약 창에서 사용자 설정 > 사용자 생성 을 선택합니다. Create User 창이 열립니다.

- 전체 이름 필드에 사용자 계정 이름을 입력합니다. 예를 들면 다음과 같습니다. Joys입니다.

사용자 이름 필드에 사용자 이름을 입력합니다(예: jsmith).

사용자 이름은 명령줄에서 로그인하는 데 사용됩니다. 그래픽 환경을 설치하는 경우 그래픽 로그인 관리자는 전체 이름을 사용합니다.

사용자가 관리 권한이 필요한 경우 Make this user administrator 확인란을 선택합니다(설치 프로그램에서 사용자를

wheel그룹에 추가합니다).관리자는

sudo명령을 사용하여root암호 대신 사용자 암호를 사용하여root에서만 사용할 수 있는 작업을 수행할 수 있습니다. 더 편리할 수도 있지만 보안 위험이 발생할 수도 있습니다.이 계정을 사용하려면 암호 필요 확인란을 선택합니다.

사용자에게 관리자 권한을 부여하는 경우 계정이 암호로 보호되었는지 확인합니다. 계정에 암호를 할당하지 않고 사용자에게 관리자 권한을 부여하지 마십시오.

- 암호 필드에 암호를 입력합니다.

- Confirm password 필드에 동일한 암호를 입력합니다.

- 을 클릭하여 변경 사항을 적용하고 Installation Summary 창으로 돌아갑니다.

6.3.3. 고급 사용자 설정 편집

다음 절차에서는 고급 사용자 구성 대화 상자에서 사용자 계정의 기본 설정을 편집하는 방법을 설명합니다.

절차

- Create User 창에서 를 클릭합니다.

-

필요한 경우 홈 디렉터리 필드에서 세부 정보를 편집합니다. 필드는 기본적으로

/home/사용자 이름으로채워집니다. 사용자 및 그룹 ID 섹션에서 다음을 수행할 수 있습니다.

수동으로 사용자 ID 지정 확인란을 선택하고 또는 를 사용하여 필요한 값을 입력합니다.

기본값은 1000입니다. UID(사용자 ID) 0-999는 시스템에서 예약하므로 사용자에게 할당할 수 없습니다.

수동으로 그룹 ID 지정 확인란을 선택하고 또는 를 사용하여 필요한 값을 입력합니다.

기본 그룹 이름은 사용자 이름과 동일하며 기본 그룹 ID(GID)는 1000입니다. GID 0-999는 시스템에서 예약하므로 사용자 그룹에 할당할 수 없습니다.

그룹 멤버십 필드에서 추가 그룹을 쉼표로 구분된 목록으로 지정합니다. 아직 존재하지 않는 그룹이 생성됩니다. 추가 그룹에 대한 사용자 지정 GID를 지정할 수 있습니다. 새 그룹에 대한 사용자 지정 GID를 지정하지 않으면 새 그룹이 GID를 자동으로 수신합니다.

생성된 사용자 계정에는 항상 하나의 기본 그룹 멤버십(사용자 ID 지정에 ID가 설정된 사용자 기본 그룹)이 있습니다.

- (변경 사항 저장)를 클릭하여 업데이트를 적용하고 Create User 창으로 돌아갑니다.

6.4. 수동 파티션 설정

수동 파티션을 사용하여 디스크 파티션 및 마운트 지점을 구성하고 Red Hat Enterprise Linux가 설치된 파일 시스템을 정의할 수 있습니다. 설치하기 전에 파티션 또는 파티션되지 않은 디스크 장치를 사용할지 여부를 고려해야 합니다. 직접 또는 LVM을 사용하여 LUN에서 파티셔닝을 사용할 때의 이점과 단점에 대한 자세한 내용은 LUN에서 파티셔닝을 사용하는 Red Hat 지식베이스 솔루션의 이점과 단점을 참조하십시오.

표준 파티션 , LVM 및 및 스토리지 옵션을 사용할 수 있습니다. 이러한 옵션은 시스템 스토리지를 효과적으로 관리하기 위한 다양한 이점과 구성을 제공합니다.

LVM 씬 프로비저닝

- 표준 파티션

-

표준 파티션에는 파일 시스템 또는 스왑 공간이 포함됩니다. 표준 파티션은

/boot및BIOS 부팅및EFI 시스템 파티션에가장 일반적으로 사용됩니다. 대부분의 다른 용도에서 LVM 논리 볼륨을 사용할 수 있습니다. - LVM

-

장치 유형으로

LVM(또는 논리 볼륨 관리)을 선택하면 LVM 논리 볼륨이 생성됩니다. LVM은 물리적 디스크를 사용할 때 성능을 향상시키고, 하나의 마운트 지점에 여러 물리적 디스크를 사용하고 성능, 안정성 또는 둘 다를 위해 소프트웨어 RAID를 설정하는 것과 같은 고급 설정을 허용합니다. - LVM 씬 프로비저닝

- 씬 프로비저닝을 사용하면 애플리케이션에서 필요할 때 임의의 수의 장치에 할당할 수 있는 씬 풀이라는 여유 공간의 스토리지 풀을 관리할 수 있습니다. 필요한 경우 스토리지 공간을 비용 효율적으로 할당하는 데 필요한 경우 풀을 동적으로 확장할 수 있습니다.

Red Hat Enterprise Linux를 설치하려면 최소 하나의 파티션이 필요하지만 / , /home, , / bootswap. 필요에 따라 추가 파티션 및 볼륨을 생성할 수도 있습니다.

데이터 손실을 방지하려면 계속하기 전에 데이터를 백업하는 것이 좋습니다. 듀얼 부팅 시스템을 업그레이드하거나 생성하는 경우 스토리지 장치에서 유지하려는 데이터를 백업해야 합니다.

6.4.1. 권장되는 파티션 스키마

다음 마운트 지점에 별도의 파일 시스템을 생성합니다. 그러나 필요한 경우 /usr,/var, /tmp 마운트 지점에 파일 시스템을 생성할 수도 있습니다.

-

/boot -

/(root) -

/home -

swap -

/boot/efi -

PReP

이 파티션 스키마는 베어 메탈 배포에는 권장되며 가상 및 클라우드 배포에는 적용되지 않습니다.

/boot파티션 - 최소 1GiB의 권장 크기-

/boot에 마운트된 파티션에는 운영 체제 커널이 포함되어 있으므로 시스템은 부트스트랩 프로세스 중에 사용되는 파일과 함께 Red Hat Enterprise Linux 8을 부팅할 수 있습니다. 대부분의 펌웨어의 제한 사항으로 인해 이러한 상태를 유지할 작은 파티션을 만듭니다. 대부분의 시나리오에서는 1GiB 부팅 파티션이 적합합니다. 다른 마운트 지점과 달리/boot에 LVM 볼륨을 사용할 수 없습니다./boot는 별도의 디스크 파티션에 있어야 합니다.

RAID 카드가 있는 경우 일부 BIOS 유형에서 RAID 카드 부팅을 지원하지 않습니다. 이러한 경우 /boot 파티션을 별도의 디스크와 같이 RAID 배열 외부의 파티션에 만들어야 합니다.

-

일반적으로

/boot파티션은 설치 프로그램에 의해 자동으로 생성됩니다. 그러나/(root) 파티션이 2TiB보다 크고 (U)EFI가 부팅에 사용되는 경우 시스템을 성공적으로 부팅하기 위해 2TiB보다 작은 별도의/boot파티션을 만들어야 합니다. -

수동 파티셔닝 중에

/boot파티션이 디스크의 처음 2TB 내에 있는지 확인합니다./boot파티션을 2TB 경계 이상으로 배치하면 설치가 성공할 수 있지만 BIOS에서 이 제한을 초과하여/boot파티션을 읽을 수 없기 때문에 시스템이 부팅되지 않습니다.

root- 권장 크기 10GiB여기서 "/" 또는 루트 디렉터리가 있습니다.

루트 디렉터리는 디렉터리 구조의 최상위 수준입니다. 기본적으로 다른 파일 시스템이 기록되는 경로에 마운트되지 않는 한,/boot또는/home과 같이 모든 파일이 이 파일 시스템에 작성됩니다.5GiB 루트 파일 시스템을 사용하면 최소 설치를 설치할 수 있지만 원하는 만큼 패키지 그룹을 설치할 수 있도록 최소 10GiB를 할당하는 것이 좋습니다.

/ 디렉토리를 /root 디렉토리와 혼동하지 마십시오. /root 디렉터리는 root 사용자의 홈 디렉터리입니다. /root 디렉토리를 루트 디렉토리와 구별하기 위해 슬래시 루트 라고도 합니다.

/home- 최소 1GiB의 권장 크기-

시스템 데이터와 별도로 사용자 데이터를 저장하려면

/home디렉터리에 대한 전용 파일 시스템을 만듭니다. 로컬에 저장된 데이터 양, 사용자 수 등에서 파일 시스템 크기를 기반으로 합니다. 사용자 데이터 파일을 삭제하지 않고 Red Hat Enterprise Linux 8을 업그레이드하거나 다시 설치할 수 있습니다. 자동 파티셔닝을 선택하는 경우/home파일 시스템이 생성되었는지 확인하려면 설치에 최소 55GiB의 디스크 공간을 사용하는 것이 좋습니다. 스왑파티션 - 권장 크기 1GiB스왑 파일 시스템은 가상 메모리를 지원합니다. 시스템은 처리 중인 데이터를 저장하기에 충분한 RAM이 없을 때 데이터가 스왑 파일 시스템에 작성됩니다. 스왑 크기는 총 시스템 메모리가 아닌 시스템 메모리의 기능이므로 총 시스템 메모리 크기와 동일하지 않습니다. 시스템이 실행 중인 애플리케이션을 분석하는 것이 중요하며 이러한 애플리케이션이 시스템 메모리 워크로드를 결정하기 위해 작동합니다. 애플리케이션 공급자 및 개발자는 지침을 제공할 수 있습니다.

시스템이 스왑 공간이 부족하면 시스템 RAM 메모리가 소모되면 커널이 프로세스를 종료합니다. 스왑 공간을 너무 많이 구성하면 스토리지 장치가 할당되지만 유휴 상태가 되고 리소스가 제대로 사용되지 않습니다. 스왑 공간이 너무 많으면 메모리 누수를 숨길 수도 있습니다. 스왑 파티션 및 기타 추가 정보의 최대 크기는

mkswap(8)매뉴얼 페이지에서 확인할 수 있습니다.다음 표에서는 시스템의 RAM 양과 시스템의 최대 절전 메모리가 필요한 경우 스왑 파티션의 권장 크기를 제공합니다. 설치 프로그램이 시스템을 자동으로 파티션하도록 하면 다음 지침을 사용하여 스왑 파티션 크기가 설정됩니다. 자동 파티션 설정은 하이버네이션을 사용하지 않는 것으로 가정합니다. 스왑 파티션의 최대 크기는 전체 디스크 크기의 10%로 제한되며 설치 프로그램은 1TiB를 초과하는 스왑 파티션을 생성할 수 없습니다. 완화를 허용할 수 있는 스왑 공간을 충분히 설정하거나 스왑 파티션 크기를 시스템의 스토리지 공간의 10% 이상으로 설정하려면 파티션 레이아웃을 수동으로 편집해야 합니다.

| 시스템의 RAM 크기 | 권장 스왑 공간 | 최대 절전 모드를 허용하는 경우 권장 스왑 공간 |

|---|---|---|

| 2GiB 미만 | RAM의 2 배 | RAM의 3 배 |

| 2GiB - 8GiB | RAM의 양과 같음 | RAM의 2 배 |

| 8GiB - 64GiB | 4GiB에서 0.5배 정도의 RAM 크기 | RAM의 1.5 배 |

| 64GiB 이상 | 워크로드에 따라 (최소 4GiB) | 최대 절전 모드는 권장되지 않음 |

/boot/efi파티션 - 권장 크기 200MiB- UEFI 기반 AMD64, Intel 64 및 64비트 ARM에는 200MiB EFI 시스템 파티션이 필요합니다. 권장 최소 크기는 200MiB이고 기본 크기는 600MiB이며 최대 크기는 600MiB입니다. BIOS 시스템에는 EFI 시스템 파티션이 필요하지 않습니다.

예를 들어 2GiB, 8GiB 또는 64GiB 시스템 RAM이 있는 시스템 간의 경계에서 선택한 스왑 공간 및 하이버네이션 지원과 관련하여 재량에 따라 재량에 따라 조치를 취할 수 있습니다. 시스템 리소스에서 허용하는 경우 스왑 공간을 늘리면 성능이 향상될 수 있습니다.

특히 빠른 드라이브, 컨트롤러 및 인터페이스가 있는 시스템에서 스왑 공간을 분산하면 스왑 공간 성능도 향상됩니다.

많은 시스템에 필요한 최소보다 많은 파티션과 볼륨이 있습니다. 특정 시스템 요구 사항에 따라 파티션을 선택합니다. 파티션 구성에 대해 잘 모르는 경우 설치 프로그램에서 제공하는 자동 기본 파티션 레이아웃을 수락합니다.

즉시 필요한 파티션에 스토리지 용량만 할당합니다. 언제든지 사용 가능한 공간을 할당하고 요구 사항을 충족할 수 있습니다.

Prep부팅 파티션 - 권장 크기 4 ~ 8MiB-

IBM Power System 서버에 Red Hat Enterprise Linux를 설치할 때 디스크의 첫 번째 파티션에

PReP부팅 파티션이 포함되어야 합니다. 여기에는 다른 IBM Power Systems 서버가 Red Hat Enterprise Linux를 부팅할 수 있는 GRUB 부트 로더가 포함되어 있습니다.

6.4.2. 지원되는 하드웨어 스토리지

스토리지 기술이 어떻게 구성되어 있고 Red Hat Enterprise Linux의 주요 버전 간에 지원이 어떻게 변경되었는지 이해하는 것이 중요합니다.

하드웨어 RAID

컴퓨터의 메인보드 또는 연결된 컨트롤러 카드에서 제공하는 모든 RAID 기능은 설치 프로세스를 시작하기 전에 구성해야 합니다. 각 활성 RAID 어레이는 Red Hat Enterprise Linux 내에서 하나의 드라이브로 표시됩니다.

소프트웨어 RAID

두 개 이상의 디스크가 있는 시스템에서는 Red Hat Enterprise Linux 설치 프로그램을 사용하여 여러 드라이브를 Linux 소프트웨어 RAID 배열로 작동할 수 있습니다. 소프트웨어 RAID 어레이를 사용하면 RAID 기능이 전용 하드웨어가 아닌 운영 체제에 의해 제어됩니다.

기존 RAID 배열의 멤버 장치가 모두 파티션되지 않은 디스크/드라이브인 경우 설치 프로그램은 배열을 디스크로 처리하고 배열을 제거할 방법이 없습니다.

USB 디스크

설치 후 외부 USB 스토리지를 연결하고 구성할 수 있습니다. 대부분의 장치는 커널에서 인식되지만 일부 장치는 인식되지 않을 수 있습니다. 설치 중에 이러한 디스크를 구성할 필요가 없는 경우 연결 해제하여 잠재적인 문제를 방지합니다.

NVDIMM 장치

NVMe(Non-Volatile Dual In-line Memory Module) 장치를 스토리지로 사용하려면 다음 조건을 충족해야 합니다.

- Red Hat Enterprise Linux 버전은 7.6 이상입니다.

- 시스템의 아키텍처는 Intel 64 또는 AMD64입니다.

- 장치는 섹터 모드로 구성됩니다. Anaconda는 NVDIMM 장치를 이 모드로 재구성할 수 있습니다.

- 장치는 nd_pmem 드라이버에서 지원해야 합니다.

다음과 같은 추가 조건에서 NVDIMM 장치에서 부팅할 수 있습니다.

- 시스템은 UEFI를 사용합니다.

- 장치는 시스템에서 사용 가능한 펌웨어 또는 UEFI 드라이버에서 지원해야 합니다. UEFI 드라이버는 장치 자체의 옵션rom에서 로드될 수 있습니다.

- 장치는 네임스페이스에서 사용할 수 있어야 합니다.

부팅 중에 NVDIMM 장치의 고성능을 활용하려면 장치에 /boot 및 /boot/efi 디렉토리를 배치합니다.

NVDIMM 장치의 Execute-in-place (XIP) 기능은 부팅 중에 지원되지 않으며 커널은 기존 메모리에 로드됩니다.

Intel BIOS RAID 세트 고려 사항

Red Hat Enterprise Linux는 Intel BIOS RAID 세트에 설치할 때 mdraid 를 사용합니다. 이러한 세트는 부팅 프로세스 중에 자동으로 감지되며 해당 장치 노드 경로는 여러 부팅 프로세스에서 변경될 수 있습니다. 장치 노드 경로(예: /dev/sda)를 파일 시스템 레이블 또는 장치 UUID로 교체합니다. blkid 명령을 사용하여 파일 시스템 레이블 및 장치 UUID를 찾을 수 있습니다.

6.4.3. 수동 파티션 시작

수동 파티션을 사용하여 요구 사항에 따라 디스크를 분할할 수 있습니다.

사전 요구 사항

- 설치 요약 화면이 열립니다.

- 모든 디스크를 설치 프로그램에서 사용할 수 있습니다.

절차

설치할 디스크를 선택합니다.

- Installation Destination 을 클릭하여 Installation Destination 창을 엽니다.

- 해당 아이콘을 클릭하여 설치에 필요한 디스크를 선택합니다. 선택한 디스크에는 확인 표시가 표시됩니다.

- 스토리지 구성에서 Custom radio-button을 선택합니다.

- 선택 사항: LUKS로 스토리지 암호화를 활성화하려면 데이터 암호화 확인란을 선택합니다.

- 을 클릭합니다.

스토리지를 암호화하도록 선택하면 디스크 암호화 암호를 입력하기 위한 대화 상자가 열립니다. LUKS 암호를 입력합니다.

두 텍스트 필드에 암호를 입력합니다. 키보드 레이아웃을 전환하려면 키보드 아이콘을 사용합니다.

주의암호를 입력하는 대화 상자에서 키보드 레이아웃을 변경할 수 없습니다. 영어 키보드 레이아웃을 선택하여 설치 프로그램에 암호를 입력합니다.

- 를 클릭합니다. 수동 파티셔닝 창이 열립니다.

감지된 마운트 지점이 왼쪽 창에 나열됩니다. 마운트 지점은 감지된 운영 체제 설치를 통해 구성됩니다. 결과적으로 파티션을 여러 설치 간에 공유하는 경우 일부 파일 시스템이 여러 번 표시될 수 있습니다.

- 왼쪽 창에서 마운트 지점을 선택합니다. 사용자 지정할 수 있는 옵션은 오른쪽 창에 표시됩니다.

- 선택 사항: 시스템에 기존 파일 시스템이 포함된 경우 설치에 충분한 공간을 사용할 수 있는지 확인합니다. 파티션을 제거하려면 목록에서 해당 파티션을 선택하고 버튼을 클릭합니다. 대화 상자에는 삭제된 파티션이 속한 시스템에서 사용하는 다른 모든 파티션을 제거하는 데 사용할 수 있는 확인란이 있습니다.

선택 사항: 기존 파티션이 없고 일련의 파티션을 시작점으로 만들려면 왼쪽 창에서 원하는 파티션 구성표를 선택하고(Red Hat Enterprise Linux의 기본값)을 클릭하고 Click here to create them automatically link를 클릭합니다.

참고사용 가능한 스토리지 크기에 비례하는

/boot스왑볼륨이 생성됩니다. 일반적인 설치를 위한 파일 시스템이지만 추가 파일 시스템과 마운트 지점을 추가할 수 있습니다.- 을 클릭하여 변경 사항을 확인하고 Installation Summary 창으로 돌아갑니다.

6.4.4. 지원되는 파일 시스템

수동 파티셔닝을 구성할 때 Red Hat Enterprise Linux에서 사용할 수 있는 다양한 파일 시스템 및 파티션 유형을 활용하여 성능을 최적화하고 호환성을 보장하며 디스크 공간을 효과적으로 관리할 수 있습니다.

- xfs

-

XFS 파일 시스템은 Red Hat Enterprise Linux의 기본 파일 시스템입니다. 확장 가능한 고성능 파일 시스템으로 최대 16 엑사바이트(약 16만 테라바이트), 최대 8 엑타바이트(약 8만 테라바이트) 파일, 수억 개의 항목이 포함된 디렉터리 구조입니다.

XFS는 메타데이터 저널링도 지원하므로 충돌 복구 속도가 빨라집니다. 단일 XFS 파일 시스템의 최대 지원 크기는 1P입니다. XFS는 여유 공간을 확보하기 위해 축소할 수 없습니다. - ext4

-

ext4파일 시스템은ext3파일 시스템을 기반으로 하며 여러 개선 사항을 제공합니다. 여기에는 대규모 파일 시스템 지원 및 대용량 파일 지원, 보다 빠르고 효율적으로 디스크 공간 할당, 디렉터리 내의 하위 디렉터리 수 제한 없음, 빠른 파일 시스템 검사, 보다 강력한 저널링이 포함됩니다. 단일ext4파일 시스템의 최대 지원 크기는 50TB입니다. - ext3

-

ext3파일 시스템은ext2파일 시스템을 기반으로 하며 저널링이라는 주요 이점이 있습니다. 저널링 파일 시스템을 사용하면 fsck 유틸리티를 실행하여 파일 시스템의 메타데이터 일관성을 확인할 필요가 없으므로 파일 시스템을 예기치 않게 종료한 후 파일 시스템을 복구하는 데 드는 시간을 줄일 수 있습니다. - ext2

-

ext2파일 시스템은 일반 파일, 디렉토리 또는 심볼릭 링크를 포함한 표준 Unix 파일 유형을 지원합니다. 최대 255자까지 긴 파일 이름을 할당할 수 있는 기능을 제공합니다. - swap

- 스왑 파티션은 가상 메모리를 지원하는 데 사용됩니다. 즉, 시스템이 처리하는 데이터를 저장하기에 RAM이 충분하지 않을 때 데이터가 스왑 파티션에 작성됩니다.

- vfat

VFAT파일 시스템은 FAT 파일 시스템에서 Microsoft Windows 긴 파일 이름과 호환되는 Linux 파일 시스템입니다.참고Linux 시스템 파티션에는

VFAT파일 시스템 지원을 사용할 수 없습니다. 예를 들면/,/var,/usr등이 있습니다.- BIOS 부팅

- BIOS 시스템 및 BIOS 호환성 모드에서 GUID 파티션 테이블 (GPT)이 있는 장치에서 부팅하는 데 필요한 매우 작은 파티션입니다.

- EFI 시스템 파티션

- UEFI 시스템에서 GUID 파티션 테이블(GPT)이 있는 장치를 부팅하는 데 필요한 작은 파티션입니다.

- PReP

-

이 작은 부팅 파티션은 디스크의 첫 번째 파티션에 있습니다.

PReP부팅 파티션에는 다른 IBM Power Systems 서버가 Red Hat Enterprise Linux를 부팅할 수 있는 GRUB2 부트 로더가 포함되어 있습니다.

6.4.5. 마운트 지점 파일 시스템 추가

여러 마운트 지점 파일 시스템을 추가할 수 있습니다. XFS, ext4, ext3,ext2, swap, VFAT, BIOS Boot, EFI System Partition 및 PReP와 같은 특정 파티션과 사용 가능한 파일 시스템 및 파티션 유형을 사용하여 시스템 스토리지를 효과적으로 구성할 수 있습니다.

사전 요구 사항

- 파티션을 계획했습니다.

-

/var/mail,/usr/tmp,/lib,/sbin,/lib64,/bin과 같은 심볼릭 링크가 있는 경로에 마운트 지점을 지정하지 않았는지 확인하십시오. RPM 패키지를 포함한 페이로드는 특정 디렉터리에 대한 심볼릭 링크 생성에 따라 다릅니다.

절차

- 를 클릭하여 새 마운트 지점 파일 시스템을 만듭니다. Add a New Mount Point 대화 상자가 열립니다.

-

마운트 지점 드롭다운 메뉴에서 사전 설정된 경로 중 하나를 선택하거나 사용자를 입력합니다. 예를 들어 부팅 파티션의 루트 파티션 또는

/boot에 대해 / 파일 시스템의 크기를 Desired Capacity 필드에 입력합니다(예:

2GiB).Desired Capacity 에서 값을 지정하지 않거나 사용 가능한 공간보다 큰 크기를 지정하는 경우 남은 모든 여유 공간이 사용됩니다.

- 를 클릭하여 파티션을 만들고 수동 파티션 창으로 돌아갑니다.

6.4.6. 마운트 지점 파일 시스템의 스토리지 구성

수동으로 생성된 각 마운트 지점의 파티션 스키마를 설정할 수 있습니다. 사용 가능한 옵션은 표준 파티션,LVM, LVM 씬 프로비저닝 입니다. Red Hat Enterprise Linux 8에서는 Btfrs 지원이 제거되었습니다.

선택한 값에 관계없이 /boot 파티션은 항상 표준 파티션에 있습니다.

절차

- LVM이 아닌 단일 마운트 지점이 있어야 하는 장치를 변경하려면 왼쪽 창에서 필요한 마운트 지점을 선택합니다.

- Device(s) 제목 아래에서 을 클릭합니다. 구성 마운트 지점 대화 상자가 열립니다.

- 하나 이상의 장치를 선택을 클릭하여 선택을 확인하고 수동 파티셔닝 창으로 돌아갑니다.

- 클릭하여 변경 사항을 적용합니다.

- 수동 파티션 창 왼쪽 하단에서 선택한 스토리지 장치를 클릭하여 선택한 디스크 대화 상자를 열고 디스크 정보를 검토합니다.

- 선택 사항: 버튼(회선 화살표 버튼)을 클릭하여 모든 로컬 디스크 및 파티션을 새로 고칩니다. 이는 설치 프로그램 외부에서 고급 파티션 구성을 수행한 후에만 필요합니다. 버튼을 클릭하면 설치 프로그램에서 수행된 모든 구성 변경 사항이 재설정됩니다.

6.4.7. 마운트 지점 파일 시스템 사용자 정의

특정 설정을 설정하려면 파티션 또는 볼륨을 사용자 지정할 수 있습니다. /usr 또는 /var 이 루트 볼륨의 나머지 부분과 별도로 분할되는 경우 이러한 디렉터리에 중요한 구성 요소가 포함되어 있으므로 부팅 프로세스가 훨씬 더 복잡해집니다. 이러한 디렉터리가 iSCSI 드라이브 또는 FCoE 위치에 배치되는 경우와 같은 일부 상황에서는 시스템을 부팅할 수 없거나 장치 의 전원을 끄거나 재부팅할 때 오류가 발생할 수 있습니다.

이 제한은 /usr 또는 /var 에만 적용되며 아래 디렉터리에는 적용되지 않습니다. 예를 들어 /var/www 의 별도의 파티션이 성공적으로 작동합니다.

절차

왼쪽 창에서 마운트 지점을 선택합니다.

그림 6.1. 파티션 사용자 정의

오른쪽 창에서 다음 옵션을 사용자 지정할 수 있습니다.

-

마운트 지점 필드에 파일 시스템 마운트 지점을 입력합니다. 예를 들어 파일 시스템이 루트 파일 시스템인 경우 / ;

/boot/boot를 입력한 후. 스왑 파일 시스템의 경우 파일 시스템 유형을swap으로 설정하는 것만으로는 마운트 지점을 설정하지 마십시오. - Desired Capacity 필드에 파일 시스템의 크기를 입력합니다. KiB 또는 GiB와 같은 일반적인 크기 단위를 사용할 수 있습니다. 다른 단위를 설정하지 않은 경우 기본값은 MiB입니다.

드롭다운 장치 유형 메뉴에서 필요한 장치 유형을 선택합니다.

표준 파티션,LVM또는LVM 프로비저닝.참고RAID는 분할을 위해 두 개 이상의 디스크가 선택된 경우에만 사용할 수 있습니다.RAID를 선택하는 경우 RAID 수준을 설정할 수도있습니다. 마찬가지로LVM을 선택하는 경우 볼륨 그룹을 지정할수 있습니다.- Encrypt 확인란을 선택하여 파티션 또는 볼륨을 암호화합니다. 나중에 설치 프로그램에서 암호를 설정해야 합니다. LUKS 버전 드롭다운 메뉴가 표시됩니다.

- 드롭다운 메뉴에서 필요한 LUKS 버전을 선택합니다.

파일 시스템 드롭다운 메뉴에서 이 파티션 또는 볼륨에 적절한 파일 시스템 유형을 선택합니다.

참고Linux 시스템 파티션에는

VFAT파일 시스템 지원을 사용할 수 없습니다. 예를 들어/,/var,/usr등.- Reformat 확인란을 선택하여 기존 파티션을 포맷하거나 데이터를 유지하려면 Reformat 확인란을 지웁니다. 새로 생성된 파티션과 볼륨을 다시 포맷해야 하며 확인란을 선택 해제할 수 없습니다.

- 레이블 필드에 파티션의 레이블을 입력합니다. 레이블을 사용하여 개별 파티션을 쉽게 인식하고 처리할 수 있습니다.

-

이름 필드에 이름을 입력합니다. 표준 파티션은 생성 시 자동으로 이름이 지정되며 표준 파티션의 이름을 편집할 수 없습니다. 예를 들어

/boot이름sda1을 편집할 수 없습니다.

-

마운트 지점 필드에 파일 시스템 마운트 지점을 입력합니다. 예를 들어 파일 시스템이 루트 파일 시스템인 경우 / ;

- 클릭하여 변경 사항을 적용하고 필요한 경우 다른 파티션을 선택하여 사용자 지정합니다. 설치 요약 창에서 시작을 클릭할 때까지 변경 사항이 적용되지 않습니다.

- 선택 사항: 을 클릭하여 파티션 변경 사항을 삭제합니다.

모든 파일 시스템 및 마운트 지점을 생성하고 사용자 지정한 경우 을 클릭합니다. 파일 시스템을 암호화하도록 선택하면 암호를 생성하라는 메시지가 표시됩니다.

설치 프로그램에 대한 모든 스토리지 작업의 요약이 표시되는 변경 사항 요약 대화 상자가 열립니다.

- 를 클릭하여 변경 사항을 적용하고 Installation Summary 창으로 돌아갑니다.

6.4.8. /home 디렉토리 유지

Red Hat Enterprise Linux 8 그래픽 설치에서는 RHEL 7 시스템에서 사용된 /home 디렉토리를 유지할 수 있습니다. /home 은 /home 디렉터리가 RHEL 7 시스템의 별도의 /home 파티션에 있는 경우에만 가능합니다.

다양한 구성 설정이 포함된 /home 디렉토리를 유지하면 새로운 Red Hat Enterprise Linux 8 시스템의 GNOME 쉘 환경이 RHEL 7 시스템에 있는 것과 동일한 방식으로 설정될 수 있습니다. 이는 이전 RHEL 7 시스템과 동일한 사용자 이름 및 ID가 있는 Red Hat Enterprise Linux 8의 사용자에게만 적용됩니다.

사전 요구 사항

- 컴퓨터에 RHEL 7이 설치되어 있어야 합니다.

-

/home디렉토리는 RHEL 7 시스템의 별도의/home파티션에 있습니다. -

Red Hat Enterprise Linux 8

설치 요약창이 열립니다.

절차

- Installation Destination 을 클릭하여 Installation Destination 창을 엽니다.

- 스토리지 구성에서 사용자 지정 라디오 버튼을 선택합니다. Done 을 클릭합니다.

- 을 클릭하면 Manual Partitioning 창이 열립니다.

/home파티션을 선택하고Mount Point:아래에/home을 입력한 다음 Reformat 확인란을 지웁니다.그림 6.2. /home이 포맷되지 않았는지 확인

-

선택 사항: 마운트 지점 파일 시스템 사용자 지정에 설명된 대로 Red Hat Enterprise Linux 8 시스템에 필요한

/home파티션의 다양한 측면을 사용자 지정할 수도 있습니다. 그러나 RHEL 7 시스템에서/home을 유지하려면 Reformat 확인란을 지워야 합니다. - 요구 사항에 따라 모든 파티션을 사용자 지정한 후 를 클릭합니다. 변경 사항 요약 대화 상자가 열립니다.

-

변경 사항 요약 대화 상자에

/home에 대한 변경 사항이 표시되지 않는지 확인합니다. 즉,/home파티션이 유지됩니다. - 을 클릭하여 변경 사항을 적용하고 설치 요약 창으로 돌아갑니다.

6.4.9. 설치 중 소프트웨어 RAID 생성

RAID(Independent Disks) 장치의 중복 배열은 성능 향상을 위해 정렬된 여러 스토리지 장치에서 구성되며 일부 구성에서는 내결함성이 향상됩니다. RAID 장치는 한 단계에서 생성되며 디스크는 필요에 따라 추가 또는 제거됩니다. 시스템의 각 물리적 디스크에 대해 하나의 RAID 파티션을 구성하여 설치 프로그램에서 사용할 수 있는 디스크 수가 사용 가능한 RAID 장치의 수준을 결정하도록 할 수 있습니다. 예를 들어 시스템에 두 개의 디스크가 있는 경우 RAID 10 장치를 생성할 수 없습니다. 최소 3개의 별도의 디스크가 필요하기 때문입니다. 시스템의 스토리지 성능과 신뢰성을 최적화하기 위해 RHEL은 설치된 시스템에 스토리지를 설정하기 위해 LVM 및 LVM Thin Provisioning을 사용하여 소프트웨어 RAID 0,RAID 1,RAID 4,RAID 5,RAID 6 및 RAID 10 유형을 지원합니다.

64비트 IBM Z에서 스토리지 하위 시스템은 RAID를 투명하게 사용합니다. 소프트웨어 RAID를 수동으로 구성할 필요는 없습니다.

사전 요구 사항

- RAID 구성 옵션이 표시되기 전에 설치를 위해 두 개 이상의 디스크를 선택했습니다. 생성할 RAID 유형에 따라 두 개 이상의 디스크가 필요합니다.

- 마운트 지점을 생성했습니다. 마운트 지점을 구성하면 RAID 장치를 구성할 수 있습니다.

- 설치 대상 창에서 라디오 버튼을 선택했습니다.

절차

- 수동 파티션 창의 왼쪽 창에서 필요한 파티션을 선택합니다.

- 장치 섹션에서 을 클릭합니다. 마운트 지점 구성 대화 상자가 열립니다.

- RAID 장치에 포함할 디스크를 선택하고 를 클릭합니다.

- 장치 유형 드롭다운 메뉴를 클릭하고 RAID 를 선택합니다.

- 파일 시스템 드롭다운 메뉴를 클릭하고 선호하는 파일 시스템 유형을 선택합니다.

- RAID 수준 드롭다운 메뉴를 클릭하고 원하는 RAID 수준을 선택합니다.

- 클릭하여 변경 사항을 저장합니다.

- 을 클릭하여 설정을 적용하여 Installation Summary 창으로 돌아갑니다.

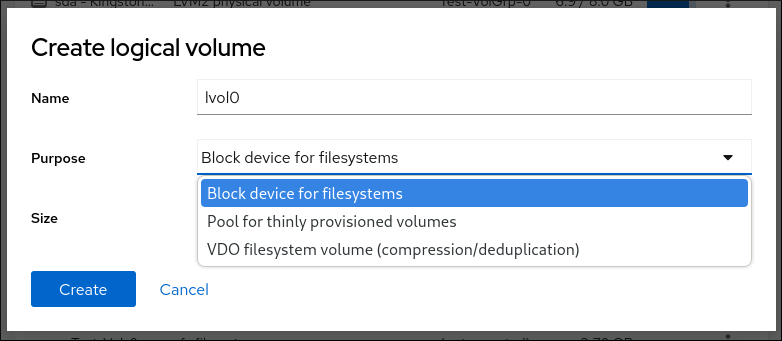

6.4.10. LVM 논리 볼륨 생성

LVM(Logical Volume Manager)은 디스크 또는 LUN과 같은 기본 물리 스토리지 공간에 대한 간단한 논리 뷰를 제공합니다. 물리 스토리지의 파티션은 볼륨 그룹으로 함께 그룹화할 수 있는 물리 볼륨으로 표시됩니다. 각 볼륨 그룹을 표준 디스크 파티션과 유사한 여러 논리 볼륨으로 나눌 수 있습니다. 따라서 LVM 논리 볼륨은 여러 물리 디스크에 걸쳐 있을 수 있는 파티션으로 작동합니다.

- LVM 구성은 그래픽 설치 프로그램에서만 사용할 수 있습니다. 텍스트 모드 설치 중에 LVM 구성을 사용할 수 없습니다.

-

LVM 구성을 생성하려면 Ctrl+Alt+F2 눌러 다른 가상 콘솔에서 쉘 프롬프트를 사용합니다. 이 쉘에서

Cryostatcreate및lvm명령을 실행할 수 있습니다. 텍스트 모드 설치로 돌아가려면 Ctrl+Alt+F1 을 누릅니다.

절차

수동 파티셔닝 창에서 다음 옵션을 사용하여 새 마운트 지점을 만듭니다.

- Click here to create them automatically 옵션을 선택하거나 + 버튼을 클릭합니다.

- 드롭다운 목록에서 마운트 지점을 선택하거나 수동으로 입력합니다.

파일 시스템의 크기를 Desired Capacity 필드에 입력합니다. 예를 들면 / , / ,

/boot참고: 기존 마운트 지점을 사용하려면 이 단계를 건너뜁니다.

- 마운트 지점을 선택합니다.

드롭다운 메뉴에서

LVM을 선택합니다. Volume Group 드롭다운 메뉴가 새로 생성된 볼륨 그룹 이름과 함께 표시됩니다.참고구성 대화 상자에서 볼륨 그룹의 물리 확장 영역의 크기를 지정할 수 없습니다. 크기는 항상 기본값인 4MiB로 설정됩니다. 다른 물리 확장 영역이 있는 볼륨 그룹을 만들려면 대화형 쉘로 전환하여 수동으로

생성하거나,volgroup --pesize=size명령으로 Kickstart 파일을 사용해야 합니다. Kickstart에 대한 자세한 내용은 RHEL 자동 설치를 참조하십시오.- 을 클릭하여 Installation Summary 창으로 돌아갑니다.

6.4.11. LVM 논리 볼륨 구성

요구 사항에 따라 새로 생성된 LVM 논리 볼륨을 구성할 수 있습니다.

LVM 볼륨에 /boot 파티션을 배치하는 것은 지원되지 않습니다.

절차

수동 파티셔닝 창에서 다음 옵션을 사용하여 마운트 지점을 만듭니다.

- Click here to create them automatically 옵션을 선택하거나 + 버튼을 클릭합니다.

- 드롭다운 목록에서 마운트 지점을 선택하거나 수동으로 입력합니다.

파일 시스템의 크기를 Desired Capacity 필드에 입력합니다. 예를 들면 / , / ,

/boot참고: 기존 마운트 지점을 사용하려면 이 단계를 건너뜁니다.

- 마운트 지점을 선택합니다.

-

장치 유형 드롭다운 메뉴를 클릭하고

LVM을 선택합니다. Volume Group 드롭다운 메뉴가 새로 생성된 볼륨 그룹 이름과 함께 표시됩니다. 를 클릭하여 새로 생성된 볼륨 그룹을 구성합니다. 볼륨 그룹 구성 대화 상자가 열립니다.

참고구성 대화 상자에서 볼륨 그룹의 물리 확장 영역의 크기를 지정할 수 없습니다. 크기는 항상 기본값인 4MiB로 설정됩니다. 다른 물리 확장 영역이 있는 볼륨 그룹을 만들려면 대화형 쉘로 전환하여 수동으로

생성하거나,volgroup --pesize=size명령으로 Kickstart 파일을 사용해야 합니다. 자세한 내용은 RHEL 자동 설치 문서를 참조하십시오.선택 사항: RAID 수준 드롭다운 메뉴에서 필요한 RAID 수준을 선택합니다.

사용 가능한 RAID 수준은 실제 RAID 장치와 동일합니다.

- Encrypt 확인란을 선택하여 암호화의 볼륨 그룹을 표시합니다.

크기 정책 드롭다운 메뉴에서 볼륨 그룹에 대해 다음 크기 정책을 선택합니다.

사용 가능한 정책 옵션은 다음과 같습니다.

- 자동

- 볼륨 그룹의 크기는 구성된 논리 볼륨을 포함할 수 있을 만큼 충분히 커지도록 자동으로 설정됩니다. 볼륨 그룹 내에서 사용 가능한 공간이 필요하지 않은 경우 최적입니다.

- 가능한 한 크게

- 볼륨 그룹은 포함된 구성된 논리 볼륨의 크기에 관계없이 최대 크기로 생성됩니다. LVM에 대부분의 데이터를 보관하고 나중에 기존 논리 볼륨의 크기를 늘리거나 이 그룹 내에 추가 논리 볼륨을 생성해야 하는 경우 최적입니다.

- 수정됨

- 볼륨 그룹의 정확한 크기를 설정할 수 있습니다. 구성된 모든 논리 볼륨은 이 고정 크기 내에 적합해야 합니다. 볼륨 그룹이 얼마나 큰지 정확히 알고 있는 경우 유용합니다.

- 클릭하여 설정을 적용하고 수동 파티셔닝 창으로 돌아갑니다.

- 클릭하여 변경 사항을 저장합니다.

- 을 클릭하여 Installation Summary 창으로 돌아갑니다.

6.4.12. 파티션에 대한 도움말

모든 시스템을 파티션하는 가장 좋은 방법은 없습니다. 최적의 설정은 설치 중인 시스템을 사용하는 방법에 따라 다릅니다. 그러나 다음 팁은 필요에 맞게 최적의 레이아웃을 찾는 데 도움이 될 수 있습니다.

- 예를 들어 특정 파티션이 특정 디스크에 있어야 하는 경우 먼저 특정 요구 사항이 있는 파티션을 만듭니다.

-

중요한 데이터를 포함할 수 있는 파티션과 볼륨을 암호화하는 것이 좋습니다. 암호화는 권한이 없는 사용자가 물리적 저장 장치에 액세스할 수 있는 경우에도 파티션의 데이터에 액세스하지 못하도록 합니다. 대부분의 경우 사용자 데이터를 포함하는

/home파티션을 최소한 암호화해야 합니다. -

경우에 따라 / ,

/boot및/homeMySQL데이터베이스를 실행하는 서버에서/var/lib/mysql에 대한 별도의 마운트 지점을 사용하면 이후에 백업에서 복원하지 않고도 데이터베이스를 다시 설치할 수 있습니다. 그러나 불필요한 마운트 지점이 있으면 스토리지 관리가 더 어려워집니다. -

일부 특수 제한 사항은 파티션 레이아웃을 배치할 수 있는 특정 디렉터리에 적용됩니다. 특히

/boot디렉토리는 항상 물리 파티션(LVM 볼륨이 아님)에 있어야 합니다. - Linux를 처음 사용하는 경우 다양한 시스템 디렉토리 및 해당 콘텐츠에 대한 정보는 Linux 파일 시스템 계층 구조 표준을 검토하는 것이 좋습니다.

- 각 커널은 대략적으로 필요합니다. 60MiB(초 34MiB, 11MiB vmlinuz, 5MiB System.map)

- 복구 모드의 경우: 100MiB(초 76MiB, 11MiB vmlinuz, 5MiB 시스템 맵)

시스템에서

kdump를 활성화하면 약 40MiB(33MiB의 다른 initrd)가 필요합니다./boot에 대한 1GiB의 기본 파티션 크기만으로도 대부분의 일반적인 사용 사례에 충분합니다. 그러나 여러 커널 릴리스 또는 에라타 커널을 유지하려는 경우 이 파티션의 크기를 늘립니다.-

/var디렉터리에는 Apache 웹 서버를 포함한 여러 애플리케이션에 대한 콘텐츠가 있으며 YUM 패키지 관리자가 다운로드한 패키지 업데이트를 임시로 저장하는 데 사용됩니다./var을 포함하는 파티션 또는 볼륨이 5GiB 이상인지 확인합니다. -

/usr디렉터리에는 일반적인 Red Hat Enterprise Linux 설치에 대부분의 소프트웨어가 있습니다. 따라서 이 디렉터리를 포함하는 파티션 또는 볼륨은 최소 설치의 경우 5GiB 이상이어야 하며 그래픽 환경이 있는 설치의 경우 최소 10GiB여야 합니다. /usr또는/var이 나머지 루트 볼륨과 별도로 분할되는 경우 이러한 디렉터리에 부팅 중요한 구성 요소가 포함되어 있기 때문에 부팅 프로세스가 훨씬 더 복잡해집니다. 이러한 디렉터리가 iSCSI 드라이브 또는 FCoE 위치에 배치되는 경우와 같은 일부 상황에서는 시스템을 부팅할 수 없거나 전원을 끄거나 재부팅할 때장치가 바빠질 수 있습니다.이 제한은

/usr또는/var에만 적용되며 그 아래의 디렉터리에는 적용되지 않습니다. 예를 들어/var/www의 별도의 파티션은 문제 없이 작동합니다.중요일부 보안 정책에서는 관리가 더 복잡해도

/usr및/var을 분리해야 합니다.-

LVM 볼륨 그룹에 할당되지 않은 공간의 일부를 두는 것이 좋습니다. 이 할당되지 않은 공간은 공간 요구 사항이 변경되었지만 다른 볼륨에서 데이터를 제거하지 않으려는 경우 유연성을 제공합니다. 파티션의

LVM Thin Provisioning장치 유형을 선택하여 사용되지 않은 공간을 볼륨에서 자동으로 처리할 수도 있습니다. - XFS 파일 시스템의 크기를 줄일 수 없습니다. 이 파일 시스템을 작은 파티션이나 볼륨을 만들어야 하는 경우 데이터를 백업하고 파일 시스템을 제거하고 그 위치에 새 파일 시스템을 생성해야 합니다. 따라서 나중에 파티션 레이아웃을 변경하려면 대신 ext4 파일 시스템을 사용해야 합니다.

-

설치 후 디스크를 추가하거나 가상 머신 디스크를 확장하여 스토리지를 확장하려는 경우 LVM(Logical Volume Manager)을 사용합니다. LVM을 사용하면 새 드라이브에 물리 볼륨을 만든 다음 적합한 볼륨 그룹 및 논리 볼륨에 할당할 수 있습니다. 예를 들어 시스템의

/home(또는 논리 볼륨에 있는 기타 디렉터리)을 쉽게 확장할 수 있습니다. - 시스템의 펌웨어, 부팅 드라이브 크기 및 부팅 드라이브 디스크 레이블에 따라 BIOS 부팅 파티션 또는 EFI 시스템 파티션을 생성해야 할 수 있습니다. 시스템에 필요하지 않은 경우 그래픽 설치에서 BIOS 부팅 또는 EFI 시스템 파티션을 생성할 수 없습니다. 이 경우 메뉴에서 숨겨집니다.

-

설치 후 스토리지 구성을 변경해야 하는 경우 Red Hat Enterprise Linux 리포지토리에서 이러한 작업을 수행하는 데 도움이 되는 여러 가지 툴을 제공합니다. 명령줄 툴을 원하는 경우

system-storage-manager를 사용해 보십시오.

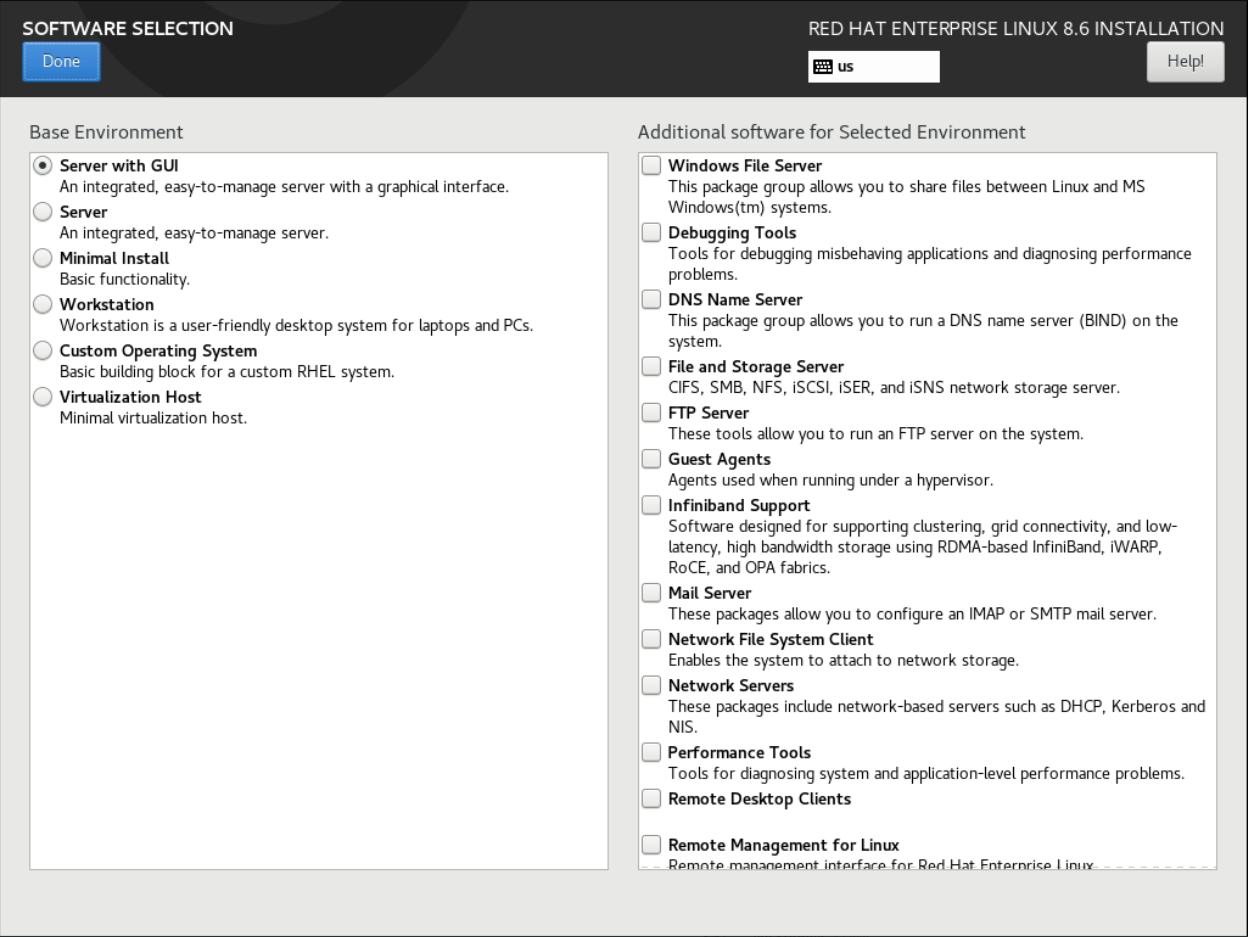

6.5. 기본 환경 및 추가 소프트웨어 선택

소프트웨어 선택 창을 사용하여 필요한 소프트웨어 패키지를 선택합니다. 패키지는 기본 환경 및 추가 소프트웨어로 구성됩니다.

- 기본 환경에는 사전 정의된 패키지가 포함되어 있습니다. 하나의 기본 환경(예: GUI(기본값), 서버, 최소 설치, 워크스테이션, 사용자 지정 운영 체제, 가상화 호스트)만 선택할 수 있습니다. 가용성은 설치 소스로 사용되는 설치 ISO 이미지에 따라 다릅니다.

- 선택한 환경에 대한 추가 소프트웨어 패키지에 는 기본 환경을 위한 추가 소프트웨어 패키지가 포함되어 있습니다. 여러 소프트웨어 패키지를 선택할 수 있습니다.

사전 정의된 환경 및 추가 소프트웨어를 사용하여 시스템을 사용자 지정합니다. 그러나 표준 설치에서는 설치할 개별 패키지를 선택할 수 없습니다. 특정 환경에 포함된 패키지를 보려면 설치 소스 미디어(DVD, CD, USB)의 리포지토리/repodata/*-comps-repository.architecture.xml 파일을 참조하십시오. XML 파일에는 기본 환경의 일부로 설치된 패키지의 세부 정보가 포함되어 있습니다. 사용 가능한 환경은 < ;environment& gt; 태그로 표시되고 추가 소프트웨어 패키지는 태그로 표시됩니다 .

설치할 패키지를 잘 모를 경우 최소 설치 기본 환경을 선택합니다. 최소 설치는 최소한의 추가 소프트웨어로 Red Hat Enterprise Linux의 기본 버전을 설치합니다. 시스템이 설치를 완료하고 처음으로 로그인하면 YUM 패키지 관리자를 사용하여 추가 소프트웨어를 설치할 수 있습니다. YUM 패키지 관리자에 대한 자세한 내용은 기본 시스템 설정 구성 문서를 참조하십시오.

-

모든 RHEL 8 시스템에서

yum group list명령을 사용하여 소프트웨어 선택의 일부로 시스템에 설치되는 패키지 목록을 확인합니다. 자세한 내용은 기본 시스템 설정 구성을 참조하십시오. -

설치된 패키지를 제어해야 하는 경우 Kickstart 파일을 사용하고

%packages섹션에 패키지를 정의할 수 있습니다.

사전 요구 사항

- 설치 소스를 구성했습니다.

- 설치 프로그램에서 패키지 메타데이터를 다운로드했습니다.

- Installation Summary 창이 열립니다.

절차

- Installation Summary 창에서 Software Selection을 클릭합니다. Software Selection 창이 열립니다.

Base Environment 창에서 기본 환경을 선택합니다. 하나의 기본 환경(예: GUI(기본값), 서버, 최소 설치, 워크스테이션, 사용자 지정 운영 체제, 가상화 호스트)만 선택할 수 있습니다. 기본적으로 GUI 기본 환경이 있는 서버 가 선택됩니다.

그림 6.3. Red Hat Enterprise Linux 소프트웨어 선택

- 선택한 환경에 대한 추가 소프트웨어 창에서 하나 이상의 옵션을 선택합니다.

- 을 클릭하여 설정을 적용하고 그래픽 설치로 돌아갑니다.

6.6. 선택 사항: 네트워크 및 호스트 이름 구성

네트워크 및 호스트 이름 창을 사용하여 네트워크 인터페이스를 구성합니다. 여기에서 선택하는 옵션은 원격 위치 및 설치된 시스템에서 패키지를 다운로드하는 것과 같은 작업을 위해 설치 중에 사용할 수 있습니다.

이 절차의 단계에 따라 네트워크 및 호스트 이름을 구성합니다.

절차

- 설치 요약 창에서 .

- 왼쪽 창의 목록에서 인터페이스를 선택합니다. 자세한 내용은 오른쪽 창에 표시됩니다.

선택한 인터페이스를 활성화하거나 비활성화하려면 스위치를 전환합니다.

인터페이스를 수동으로 추가하거나 제거할 수 없습니다.

- 를 클릭하여 가상 네트워크 인터페이스를 추가합니다. 팀, 본딩, 브리지 또는 VLAN.

- 를 클릭하여 가상 인터페이스를 제거합니다.

- (구성)를 클릭하여 IP 주소, DNS 서버 또는 기존 인터페이스(가상 및 물리적)의 라우팅 구성과 같은 설정을 변경합니다.

호스트 이름 필드에 시스템의 호스트 이름을 입력합니다.

호스트 이름은

hostname.domainname형식의 FQDN(정규화된 도메인 이름)이거나 도메인이 없는 짧은 호스트 이름일 수 있습니다. 많은 네트워크에는 연결된 시스템에 도메인 이름을 자동으로 제공하는 DHCP(Dynamic Host Configuration Protocol) 서비스가 있습니다. DHCP 서비스에서 이 시스템에 도메인 이름을 할당할 수 있도록 하려면 짧은 호스트 이름만 지정합니다.호스트 이름에는 영숫자 및

-또는 . .만 포함할 수 있습니다.호스트 이름은 64자 이상이어야 합니다. 호스트 이름은-및 로 시작하거나 종료할 수 없습니다.DNS를 준수하기 위해 FQDN의 각 부분은 63자 이상이어야 하며 점을 포함한 전체 FQDN 길이는 255자를 초과해서는 안 됩니다.localhost값은 대상 시스템의 특정 정적 호스트 이름이 구성되지 않으며, 설치된 시스템의 실제 호스트 이름은 네트워크 구성 처리 중에 구성됩니다(예: DHCP 또는 DNS를 사용하는 NetworkManager에 의해).고정 IP 및 호스트 이름 구성을 사용하는 경우 계획된 시스템 사용 사례에 따라 짧은 이름 또는 FQDN을 사용할지 여부에 따라 달라집니다. Red Hat Identity Management는 프로비저닝 중에 FQDN을 구성하지만 일부 타사 소프트웨어 제품에는 짧은 이름이 필요할 수 있습니다. 두 경우 모두 모든 상황에서 두 양식의 가용성을 보장하기 위해

IP FQDN short-alias형식으로/etc/hosts의 호스트에 대한 항목을 추가합니다.- 를 클릭하여 설치 프로그램 환경에 호스트 이름을 적용합니다.

- 또는 네트워크 및 호스트 이름 창에서 wireless 옵션을 선택할 수 있습니다. 오른쪽 창에서 클릭하여 Cryostat 연결을 선택하고 필요한 경우 암호를 입력한 다음 를 클릭합니다.

6.6.1. 가상 네트워크 인터페이스 추가

가상 네트워크 인터페이스를 추가할 수 있습니다.

절차

- 네트워크 및 호스트 이름 창에서 버튼을 클릭하여 가상 네트워크 인터페이스를 추가합니다. 장치 추가 대화 상자가 열립니다.

사용 가능한 가상 인터페이스의 네 가지 유형 중 하나를 선택합니다.

- 본딩: NIC(Network Interface Controller) 본딩은 여러 물리적 네트워크 인터페이스를 단일 결합된 채널에 결합하는 방법입니다.

- 브리지: 여러 별도의 네트워크를 하나의 집계 네트워크에 연결하는 방법인 NIC 브리징을 나타냅니다.

- 팀: NIC 티밍은 작은 커널 드라이버를 제공하여 패킷 흐름의 빠른 처리를 구현하고 다양한 애플리케이션에서 사용자 공간의 다른 모든 작업을 수행하도록 설계된 새로운 구현입니다.

- VLAN (가상 LAN): 상호 격리되는 여러 개의 개별 브로드캐스트 도메인을 생성하는 방법입니다.

인터페이스 유형을 선택하고 를 클릭합니다. 선택한 인터페이스 유형에 대해 사용 가능한 설정을 편집할 수 있는 편집 인터페이스 대화 상자가 열립니다.

자세한 내용은 네트워크 인터페이스 편집을 참조하십시오.

- 클릭하여 가상 인터페이스 설정을 확인하고 Network & Host name 창으로 돌아갑니다.

- 선택 사항: 가상 인터페이스의 설정을 변경하려면 인터페이스를 선택하고 를 클릭합니다.

6.6.2. 네트워크 인터페이스 구성 편집

설치 중에 사용되는 일반적인 유선 연결의 구성을 편집할 수 있습니다. 다른 유형의 네트워크 구성은 특정 구성 매개변수가 다를 수 있지만 광범위하게 유사합니다.

64비트 IBM Z에서는 네트워크 하위 채널을 그룹화하고 사전에 온라인 상태로 설정해야 하므로 새 연결을 추가할 수 없으며 현재 부팅 단계에서만 수행됩니다.

절차

네트워크 연결을 수동으로 구성하려면 네트워크 및 호스트 이름 창에서 인터페이스를 선택하고 를 클릭합니다.

선택한 인터페이스와 관련된 편집 대화 상자가 열립니다. 존재하는 옵션은 연결 유형에 따라 달라집니다. 사용 가능한 옵션은 연결 유형이 물리적 인터페이스(선선 또는 무선 네트워크 인터페이스 컨트롤러)인지 아니면 이전에 가상 인터페이스 추가 에서 구성한 가상 인터페이스(Bond, Bridge, Team 또는 Vlan)인지 여부에 따라 약간 다릅니다.

6.6.3. 인터페이스 연결 활성화 또는 비활성화

특정 인터페이스 연결을 활성화하거나 비활성화할 수 있습니다.

절차

- 일반 탭을 클릭합니다.

-

우선 순위로 자동으로 연결 확인란을 선택하여 연결을 기본적으로 활성화합니다. 기본 우선순위 설정을

0에서 유지합니다. 선택 사항: All users may connect to this network option을 사용하여 시스템의 모든 사용자가 이 네트워크에 연결하지 않도록 설정 또는 비활성화합니다. 이 옵션을 비활성화하면

root만 이 네트워크에 연결할 수 있습니다.중요유선 연결에서 활성화된 경우 시스템을 시작하거나 재부팅하는 동안 시스템이 자동으로 연결됩니다. 무선 연결에서 인터페이스는 범위의 알려진 무선 네트워크에 연결을 시도합니다.

nm-connection-editor툴을 포함한 NetworkManager에 대한 자세한 내용은 네트워킹 구성 및 관리를 참조하십시오.클릭하여 변경 사항을 적용하고 네트워크 및 호스트 이름 창으로 돌아갑니다.

설치 중 이 시점에서 다른 사용자가 생성되지 않으므로

root이외의 사용자만 이 인터페이스를 사용할 수 없습니다. 다른 사용자에 대한 연결이 필요한 경우 설치 후 구성해야 합니다.

6.6.4. 정적 IPv4 또는 IPv6 설정 설정

기본적으로 IPv4 및 IPv6는 현재 네트워크 설정에 따라 자동 구성으로 설정됩니다. 즉, 인터페이스가 네트워크에 연결될 때 로컬 IP 주소, DNS 주소 및 기타 설정과 같은 주소가 자동으로 감지됩니다. 대부분의 경우 이 문제로는 충분하지만 IPv4 설정 및 IPv6 설정 탭에 정적 구성을 제공할 수도 있습니다. IPv4 또는 IPv6 설정을 구성하려면 다음 단계를 완료합니다.

절차

- 정적 네트워크 구성을 설정하려면 IPv Settings 탭 중 하나로 이동하고 Method 드롭다운 메뉴에서 Automatic 이외의 방법을 선택합니다(예: Manual ). Address pane이 활성화되어 있습니다.

- 선택 사항: IPv6 설정 탭에서 이 인터페이스에서 IPv6를 비활성화하도록 메서드를 Ignore 로 설정할 수도 있습니다.

- 클릭하고 주소 설정을 입력합니다.

-

추가 DNS servers 필드에 IP 주소를 입력합니다. DNS 서버의 IP 주소를 하나 이상 허용합니다(예:

10.0.0.1,10.0.0.8). 이 연결을 위해 Require IPvX addressing for this connection to complete 확인란을 선택합니다.

IPv4 설정 또는 IPv 6 설정 탭에서 이 옵션을 선택하면 IPv 4 또는 IPv6에 성공한 경우에만 이 연결을 허용합니다. IPv4 및 IPv6 모두에 대해 이 옵션이 비활성화된 상태로 남아 있으면 구성이 IP 프로토콜에서 성공하면 인터페이스가 연결할 수 있습니다.

- 클릭하여 변경 사항을 적용하고 네트워크 및 호스트 이름 창으로 돌아갑니다.

6.6.5. 경로 구성

경로를 구성하여 특정 연결 액세스를 제어할 수 있습니다.

절차

- IPv4 설정 및 IPv6 설정 탭에서 클릭하여 인터페이스에서 특정 IP 프로토콜에 대한 라우팅 설정을 구성합니다. 인터페이스와 관련된 편집 경로 대화 상자가 열립니다.

- 를 클릭하여 경로를 추가합니다.

- Ignore automatically obtained routes 확인란을 선택하여 하나 이상의 정적 경로를 구성하고 특별히 구성되지 않은 모든 경로를 비활성화합니다.

네트워크 상의 리소스에만 이 연결 사용 확인란을 선택하여 연결이 기본 경로가 되지 않도록 합니다.

이 옵션은 정적 경로를 구성하지 않은 경우에도 선택할 수 있습니다. 이 경로는 로컬 또는 VPN 연결이 필요한 인트라넷 페이지와 같은 특정 리소스에 액세스하는 데만 사용됩니다. 다른 (기본) 경로는 공개적으로 사용 가능한 리소스에 사용됩니다. 구성된 추가 경로와 달리 이 설정은 설치된 시스템으로 전송됩니다. 이 옵션은 둘 이상의 인터페이스를 구성할 때만 유용합니다.

- 클릭하여 설정을 저장하고 인터페이스와 관련된 편집 경로 대화 상자로 돌아갑니다.

- 클릭하여 설정을 적용하고 네트워크 및 호스트 이름 창으로 돌아갑니다.

6.7. 선택 사항: 키보드 레이아웃 구성

설치 요약 화면에서 키보드 레이아웃을 구성할 수 있습니다.

러시아어 와 같이 라틴 문자를 허용할 수 없는 레이아웃을 사용하는 경우 영어(United States) 레이아웃을 추가하고 두 레이아웃 간에 전환하도록 키보드 조합을 구성합니다. 라틴 문자가 없는 레이아웃을 선택하는 경우 나중에 설치 프로세스에서 유효한 root 암호 및 사용자 인증 정보를 입력하지 못할 수 있습니다. 이로 인해 설치를 완료하지 못할 수 있습니다.

절차

- 설치 요약 창에서 Cryo stat 를 클릭합니다.

- 를 클릭하여 Add a Cryostat Layout 창을 열어 다른 레이아웃으로 변경합니다.

- 목록을 검색하여 레이아웃을 선택하거나 검색 필드를 사용합니다.

- 필요한 레이아웃을 선택하고 를 클릭합니다. 새 레이아웃이 기본 레이아웃 아래에 표시됩니다.

- 클릭하여 사용 가능한 레이아웃을 순환하는 데 사용할 수 있는 키보드 스위치를 선택적으로 구성합니다. 레이아웃 전환 옵션 창이 열립니다.

- 전환에 사용할 키 조합을 구성하려면 하나 이상의 키 조합을 선택하고 를 클릭하여 선택을 확인합니다.

- 선택 사항: 레이아웃을 선택할 때 Cryostat 버튼을 클릭하여 선택한 레이아웃의 시각적 표현이 표시되는 새 대화 상자를 엽니다.

- 을 클릭하여 설정을 적용하고 그래픽 설치로 돌아갑니다.

6.8. 선택 사항: 언어 지원 구성

설치 요약 화면에서 언어 설정을 변경할 수 있습니다.

절차

- 설치 요약 창에서 언어 지원을 클릭합니다. 언어 지원 창이 열립니다. 왼쪽 창에는 사용 가능한 언어 그룹이 나열됩니다. 그룹에서 하나 이상의 언어가 구성된 경우 확인 표시가 표시되고 지원되는 언어가 강조 표시됩니다.

- 왼쪽 창에서 그룹을 클릭하여 추가 언어를 선택하고 오른쪽 창에서 지역 옵션을 선택합니다. 구성하려는 모든 언어에 대해 이 프로세스를 반복합니다.

- 선택 사항: 필요한 경우 텍스트 상자에 입력하여 언어 그룹을 검색합니다.

- 을 클릭하여 설정을 적용하고 그래픽 설치로 돌아갑니다.

6.10. 선택 사항: Red Hat Insights 서브스크립션 및 활성화

Red Hat Insights는 등록된 Red Hat 기반 시스템에 대한 지속적인 심층적인 분석을 제공하여 물리적, 가상 및 클라우드 환경 및 컨테이너 배포 전반에 걸쳐 보안, 성능 및 안정성에 대한 위협을 사전에 식별하는 SaaS(Software-as-a-Service) 서비스입니다. Red Hat Insights에 RHEL 시스템을 등록하면 예측 분석, 보안 경고 및 성능 최적화 툴에 액세스할 수 있으므로 안전하고 효율적이며 안정적인 IT 환경을 유지할 수 있습니다.

Red Hat 계정 또는 활성화 키 세부 정보를 사용하여 Red Hat에 등록할 수 있습니다. Red Hat에 연결 옵션을 사용하여 시스템을 Red Hat Insights에 연결할 수 있습니다.

절차

- 설치 요약 화면에서 소프트웨어에서 Red Hat에 연결을 클릭합니다.

계정 또는 활성화 키를 선택합니다.

- 계정을 선택하는 경우 Red Hat 고객 포털 사용자 이름과 암호 세부 정보를 입력합니다.

활성화 키를 선택하는 경우 조직 ID 및 활성화 키를 입력합니다.

활성화 키가 서브스크립션에 등록된 경우 두 개 이상의 활성화 키를 쉼표로 구분할 수 있습니다.

Set System Purpose 확인란을 선택합니다.

- 계정에 Simple Content Access 모드가 활성화된 경우에도 시스템 용도 값을 설정하는 것이 서브스크립션 서비스의 소비를 정확하게 보고하는 데 여전히 중요합니다.

- 귀하의 계정이 인타이틀먼트 모드에 있는 경우, 시스템 용도를 통해 인타이틀먼트 서버가 Red Hat Enterprise Linux 8 시스템의 의도된 사용을 충족하기 위해 가장 적합한 서브스크립션을 결정하고 자동으로 연결할 수 있습니다.

- 해당 드롭다운 목록에서 필요한 Role,SLA 및 Usage 를 선택합니다.

- Red Hat Insights에 연결 확인란은 기본적으로 활성화되어 있습니다. Red Hat Insights에 연결하지 않으려면 확인란의 선택을 해제합니다.

선택 사항: 옵션을 확장합니다.

- 네트워크 환경에서 외부 인터넷 액세스만 허용하거나 HTTP 프록시를 통해 콘텐츠 서버에 액세스할 수 있는 경우 HTTP 프록시 사용 확인란을 선택합니다. HTTP 프록시를 사용하지 않는 경우 HTTP 프록시 사용 확인란의 선택을 해제합니다.

Satellite Server를 실행 중이거나 내부 테스트를 수행하는 경우 Custom Server URL 및 Custom base URL 확인란을 선택하고 필요한 세부 정보를 입력합니다.

중요-

Custom Server URL 필드에는 HTTP 프로토콜(예:

nameofhost.com)이 필요하지 않습니다. 그러나 사용자 정의 기본 URL 필드에는 HTTP 프로토콜이 필요합니다. - 등록 후 사용자 정의 기본 URL 을 변경하려면 등록 취소, 새 세부 정보를 제공한 다음 다시 등록해야 합니다.

-

Custom Server URL 필드에는 HTTP 프로토콜(예:

을 클릭하여 시스템을 등록합니다. 시스템이 성공적으로 등록되고 서브스크립션이 연결되면 Red Hat에 연결 창에 연결된 서브스크립션 세부 정보가 표시됩니다.

서브스크립션 수에 따라 등록 및 첨부 프로세스를 완료하는 데 최대 1분이 걸릴 수 있습니다.

을 클릭하여 Installation Summary 창으로 돌아갑니다.

Red Hat Connect to Red Hat 에 등록된 메시지가 표시됩니다.

6.11. 선택 사항: 설치에 네트워크 기반 리포지토리 사용

자동 감지 설치 미디어, Red Hat CDN 또는 네트워크에서 설치 소스를 구성할 수 있습니다. 설치 요약 창이 처음 열 때 설치 프로그램은 시스템을 부팅하는 데 사용된 미디어 유형에 따라 설치 소스를 구성하려고 합니다. 전체 Red Hat Enterprise Linux Server DVD는 소스를 로컬 미디어로 구성합니다.

사전 요구 사항

- 제품 다운로드 페이지에서 전체 설치 DVD ISO 또는 최소 설치 부팅 ISO 이미지를 다운로드 했습니다.

- 부팅 가능한 설치 미디어가 생성되어 있습니다.

- Installation Summary 창이 열립니다.

절차

Installation Summary 창에서 Installation Source 를 클릭합니다. 설치 소스 창이 열립니다.

- 자동 감지 설치 미디어 섹션을 검토하여 세부 정보를 확인합니다. 설치 소스가 포함된 미디어에서 설치 프로그램을 시작한 경우(예: DVD) 이 옵션이 기본적으로 선택됩니다.

- 을 클릭하여 미디어 무결성을 확인합니다.

추가 리포지토리 섹션을 검토하고 AppStream 확인란이 기본적으로 선택되어 있는지 확인합니다.

BaseOS 및 AppStream 리포지토리는 전체 설치 이미지의 일부로 설치됩니다. 전체 Red Hat Enterprise Linux 8을 설치하려면 AppStream 리포지토리 확인란을 비활성화하지 마십시오.

- 선택 사항: Red Hat CDN 옵션을 선택하여 시스템을 등록하고 RHEL 서브스크립션을 연결한 후 Red Hat CDN(Content Delivery Network)에서 RHEL을 설치합니다.

선택 사항: On the network 옵션을 선택하여 로컬 미디어 대신 네트워크 위치에서 패키지를 다운로드하고 설치합니다. 이 옵션은 네트워크 연결이 활성화된 경우에만 사용할 수 있습니다. GUI에서 네트워크 연결을 구성하는 방법에 대한 정보는 네트워크 및 호스트 이름 옵션 구성 을 참조하십시오.

참고네트워크 위치에서 추가 리포지토리를 다운로드하여 설치하지 않으려면 소프트웨어 선택 구성 로 이동합니다.

- On the network 드롭다운 메뉴를 선택하여 패키지 다운로드 프로토콜을 지정합니다. 이 설정은 사용하려는 서버에 따라 다릅니다.

-

주소 필드에 서버 주소(프로토콜 제외)를 입력합니다. NFS를 선택하면 사용자 지정 NFS 마운트 옵션을 지정할 수 있는 두 번째 입력 필드가 열립니다. 이 필드는 시스템의

nfs(5)도움말 페이지에 나열된 옵션을 허용합니다. NFS 설치 소스를 선택할 때 호스트 이름을 경로와 분리하는 콜론(

:) 문자가 있는 주소를 지정합니다. 예를 들어server.example.com:/path/to/directory.다음 단계는 선택 사항이며 네트워크 액세스에 프록시를 사용하는 경우에만 필요합니다.

- HTTP 또는 HTTPS 소스에 대한 프록시를 구성하려면 프록시 클릭합니다.

- Enable HTTP proxy 확인란을 선택하고 Proxy Host 필드에 URL을 입력합니다.

- 프록시 서버에 인증이 필요한 경우 Use Authentication 확인란을 선택합니다.

- 사용자 이름과 암호를 입력합니다.

를 클릭하여 구성을 완료하고 Proxy 설정…을 종료합니다. 대화 상자.

참고HTTP 또는 HTTPS URL이 저장소 미러를 참조하는 경우 URL 유형 드롭다운 목록에서 필요한 옵션을 선택합니다. 소스 구성을 완료하면 모든 환경 및 추가 소프트웨어 패키지를 선택할 수 있습니다.

- 를 클릭하여 리포지토리를 추가합니다.

- 리포지토리를 삭제하려면 를 클릭합니다.

- 설치 소스 창을 열 때 아이콘을 클릭하여 현재 항목을 설정으로 되돌립니다.

리포지토리를 활성화하거나 비활성화하려면 목록의 각 항목에 대해 Enabled 열에서 확인란을 클릭합니다.

네트워크의 기본 리포지토리와 동일한 방식으로 추가 리포지토리의 이름을 지정하고 구성할 수 있습니다.

- 을 클릭하여 설정을 적용하고 Installation Summary 창으로 돌아갑니다.

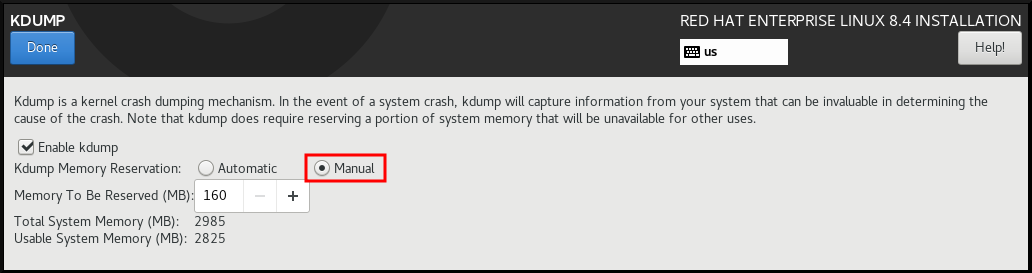

6.12. 선택 사항: Kdump 커널 크래시 덤프 메커니즘 구성

kdump 는 커널 크래시 덤프 메커니즘입니다. 시스템 충돌이 발생하는 경우 Kdump 는 오류 발생 시 시스템 메모리의 콘텐츠를 캡처합니다. 이 캡처된 메모리는 충돌의 원인을 확인하기 위해 분석될 수 있습니다. Kdump 가 활성화된 경우 시스템 메모리(RAM)의 일부가 자체적으로 예약되어 있어야 합니다. 이 예약된 메모리는 기본 커널에서 액세스할 수 없습니다.

절차

- Installation Summary 창에서 Kdump 를 클릭합니다. Kdump 창이 열립니다.

- kdump 활성화 확인란을 선택합니다.

- 자동 또는 수동 메모리 예약 설정을 선택합니다.

- Manual 을 선택하는 경우 + 및 - 버튼을 사용하여 예약할 메모리에 예약할 메모리 양(MB)을 입력합니다. 예약 입력 필드 아래에 있는 시스템 메모리 읽기 필드는 선택한 RAM 용량을 예약한 후 기본 시스템에 액세스할 수 있는 메모리 양을 보여줍니다.

- 을 클릭하여 설정을 적용하고 그래픽 설치로 돌아갑니다.

예약한 메모리 양은 시스템 아키텍처(AMD64 및 Intel 64의 경우 IBM Power와 다른 요구 사항)와 총 시스템 메모리 양에 따라 결정됩니다. 대부분의 경우 자동 예약은 만족스럽습니다.

커널 크래시 덤프를 저장할 위치와 같은 추가 설정은 system-config-kdump 그래픽 인터페이스를 사용하거나 /etc/kdump.conf 구성 파일에서 수동으로 설치한 후에만 구성할 수 있습니다.

6.13. 선택 사항: 보안 프로필 선택

Red Hat Enterprise Linux 8 설치 중에 보안 정책을 적용하고 처음 부팅하기 전에 시스템에서 사용하도록 구성할 수 있습니다.

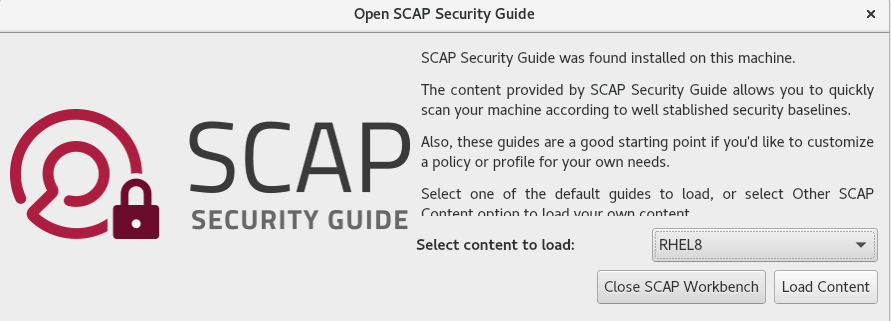

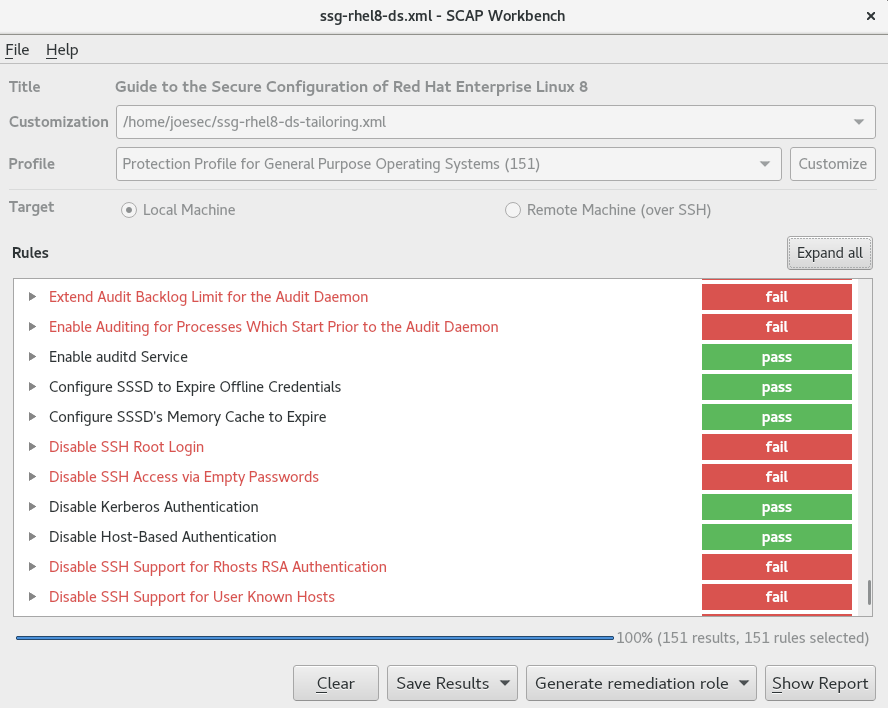

6.13.1. 보안 정책 정보

Red Hat Enterprise Linux에는 특정 보안 정책과 일치하여 시스템의 자동 구성을 활성화하는 OpenSCAP 제품군이 포함되어 있습니다. 이 정책은 SCAP(Security Content Automation Protocol) 표준을 사용하여 구현됩니다. 패키지는 AppStream 리포지토리에서 사용할 수 있습니다. 그러나 기본적으로 설치 및 설치 후 프로세스는 정책을 적용하지 않으므로 구체적으로 구성하지 않는 한 검사가 수행되지 않습니다.

보안 정책을 적용하는 것은 설치 프로그램의 필수 기능이 아닙니다. 시스템에 보안 정책을 적용하면 선택한 프로필에 정의된 제한을 사용하여 설치됩니다. openscap-scanner 및 scap-security-guide 패키지가 패키지 선택에 추가되어 규정 준수 및 취약점 검사를 위한 사전 설치된 도구가 제공됩니다.

보안 정책을 선택할 때 Anaconda GUI 설치 프로그램은 정책의 요구 사항을 준수하기 위해 구성이 필요합니다. 패키지 선택과 개별 파티션이 충돌할 수 있습니다. 모든 요구 사항이 충족된 후에만 설치를 시작할 수 있습니다.

설치 프로세스가 끝나면 선택한 OpenSCAP 보안 정책이 시스템을 자동으로 강화하여 규정 준수를 확인하여 검사 결과를 설치된 시스템의 /root/openscap_data 디렉터리에 저장합니다.

기본적으로 설치 프로그램은 설치 이미지에 번들된 scap-security-guide 패키지의 콘텐츠를 사용합니다. HTTP, HTTPS 또는 FTP 서버에서 외부 콘텐츠를 로드할 수도 있습니다.

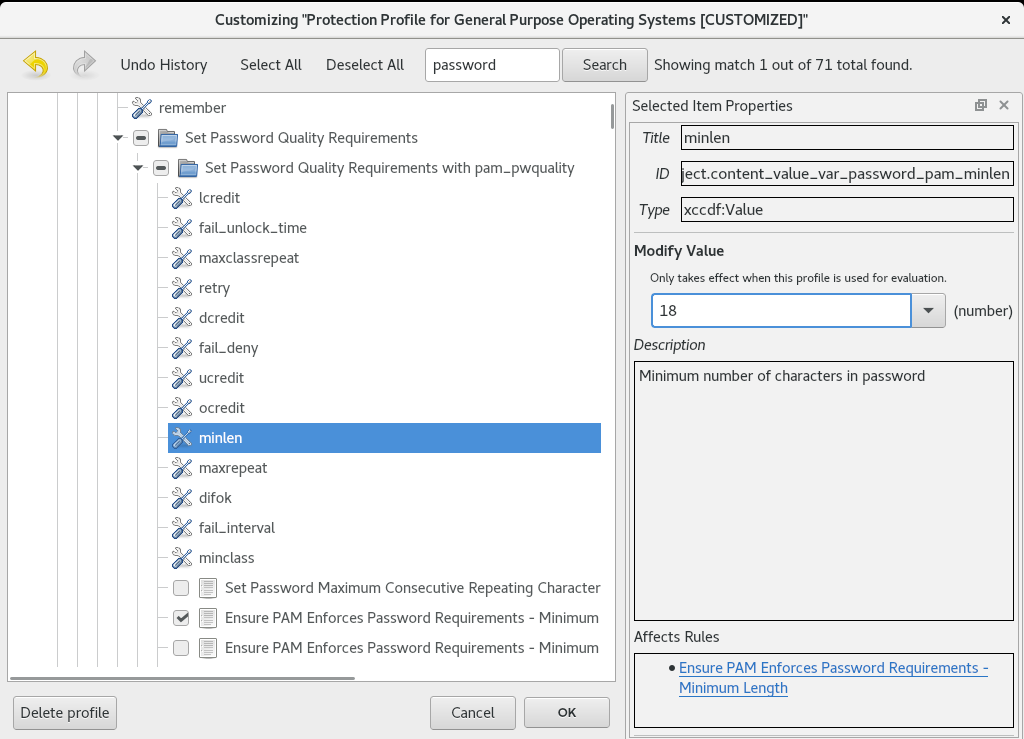

6.13.2. 보안 프로필 구성

설치 요약 창에서 보안 정책을 구성할 수 있습니다.

사전 요구 사항

- Installation Summary 창이 열립니다.

절차

- 설치 요약 창에서 보안 프로필 을 클릭합니다. Security Profile 창이 열립니다.

- 시스템에서 보안 정책을 활성화하려면 Apply security policy을 ON으로 전환합니다.

- 상단 창에 나열된 프로필 중 하나를 선택합니다.

클릭합니다.

설치 아래에 표시되기 전에 적용해야 하는 프로필 변경 사항입니다.

사용자 지정 프로필을 사용하려면 클릭합니다.

유효한 보안 콘텐츠에 대한 URL을 입력할 수 있는 별도의 창이 열립니다.

를 클릭하여 URL을 검색합니다.

HTTP,HTTPS 또는 FTP 서버에서 사용자 지정 프로필을 로드할 수 있습니다. 프로토콜을 포함하여 콘텐츠의 전체 주소를 사용합니다(예: http:// ). 사용자 지정 프로필을 로드하려면 네트워크 연결을 활성화해야 합니다. 설치 프로그램은 콘텐츠 유형을 자동으로 감지합니다.

- 를 클릭하여 Security Profile 창으로 돌아갑니다.

- 을 클릭하여 설정을 적용하고 Installation Summary 창으로 돌아갑니다.

6.13.3. GUI에서 서버와 호환되지 않는 프로파일

SCAP 보안 가이드의 일부로 제공되는 특정 보안 프로필은 GUI 기본 환경에서 서버에 포함된 확장 패키지 세트와 호환되지 않습니다. 따라서 다음 프로필 중 하나와 호환되는 시스템을 설치할 때 GUI를 사용하여 서버를 선택하지 마십시오.

| 프로파일 이름 | 프로파일 ID | 이유 | 참고 |

|---|---|---|---|

| CIS Red Hat Enterprise Linux 8 Benchmark for Level 2 - 서버 |

|

패키지 | |

| CIS Red Hat Enterprise Linux 8 Benchmark for Level 1 - 서버 |

|

패키지 | |

| 비연방 정보 시스템 및 조직의 분류되지 않은 정보(NIST 800-171) |

|

| |

| 일반적인 용도 운영 체제를 위한 보안 프로필 |

|

| |

| DISA STIG for Red Hat Enterprise Linux 8 |

|

패키지 | RHEL 버전 8.4 이상에서 GUI 가 DISA STIG에 맞는 서버로 RHEL 시스템을 설치하려면 GUI 프로필과 함께 DISA STIG 를 사용할 수 있습니다. |

6.13.4. Kickstart를 사용하여 기준 준수 RHEL 시스템 배포

특정 기준과 일치하는 RHEL 시스템을 배포할 수 있습니다. 이 예에서는 OSDPP(General Purpose Operating System)에 보안 프로필을 사용합니다.

사전 요구 사항

-

scap-security-guide패키지는 RHEL 8 시스템에 설치됩니다.

절차

-

선택한 편집기에서

/usr/share/scap-security-guide/kickstart/ssg-rhel8-ospp-ks.cfgKickstart 파일을 엽니다. -

구성 요구 사항에 맞게 파티션 구성표를 업데이트합니다. OSPP 규정 준수의 경우

/boot,/home,/var,/tmp,/var/log,/var/tmp,/var/log/audit에 대한 별도의 파티션을 유지해야 하며 파티션 크기를 변경할 수 있습니다. - Kickstart를 사용하여 자동 설치를 수행하는 방법에 설명된 대로 Kickstart 설치를 시작합니다.

Kickstart 파일의 암호는 OSPP 요구 사항에 대해 확인되지 않습니다.

검증

설치가 완료된 후 시스템의 현재 상태를 확인하려면 시스템을 재부팅하고 새 검사를 시작합니다.

oscap xccdf eval --profile ospp --report eval_postinstall_report.html /usr/share/xml/scap/ssg/content/ssg-rhel8-ds.xml

# oscap xccdf eval --profile ospp --report eval_postinstall_report.html /usr/share/xml/scap/ssg/content/ssg-rhel8-ds.xmlCopy to Clipboard Copied! Toggle word wrap Toggle overflow

7장. 서브스크립션 서비스 변경

서브스크립션을 관리하려면 Red Hat Subscription Management Server 또는 Red Hat Satellite Server로 RHEL 시스템을 등록할 수 있습니다. 필요한 경우 나중에 서브스크립션 서비스를 변경할 수 있습니다. 등록된 서브스크립션 서비스를 변경하려면 현재 서비스에서 시스템을 등록 해제한 다음 새 서비스에 등록합니다.

시스템 업데이트를 받으려면 시스템을 관리 서버 중 하나에 등록합니다.

이 섹션에서는 Red Hat Subscription Management Server 및 Red Hat Satellite Server에서 RHEL 시스템을 등록 해제하는 방법에 대해 설명합니다.

사전 요구 사항

다음 중 하나에 시스템을 등록했습니다.

- Red Hat Subscription Management Server

- Red Hat Satellite Server 버전 6.11

시스템 업데이트를 받으려면 시스템을 관리 서버 중 하나에 등록합니다.

7.1. 서브스크립션 관리 서버에서 등록 취소

이 섹션에서는 명령줄 및 서브스크립션 관리자 사용자 인터페이스를 사용하여 Red Hat Subscription Management Server에서 RHEL 시스템을 등록 해제하는 방법에 대해 설명합니다.

7.1.1. 명령줄을 사용하여 등록 취소

unregister 명령을 사용하여 Red Hat Subscription Management Server에서 RHEL 시스템을 등록 취소합니다.

절차

추가 매개 변수 없이 등록 취소 명령을 root 사용자로 실행합니다.

subscription-manager unregister

# subscription-manager unregisterCopy to Clipboard Copied! Toggle word wrap Toggle overflow - 메시지가 표시되면 root 암호를 입력합니다.

시스템은 서브스크립션 관리 서버에서 등록 취소되며 '시스템이 현재 등록되지 않은 상태' 상태는 버튼이 활성화된 상태로 표시됩니다.

중단되지 않는 서비스를 계속하려면 시스템을 관리 서비스 중 하나로 다시 등록합니다. 시스템을 관리 서비스에 등록하지 않으면 시스템 업데이트를 받지 못할 수 있습니다. 시스템 등록에 대한 자세한 내용은 명령줄을 사용하여 시스템 등록을 참조하십시오.

7.1.2. 서브스크립션 관리자 사용자 인터페이스를 사용하여 등록 해제

Subscription Manager 사용자 인터페이스를 사용하여 Red Hat Subscription Management Server에서 RHEL 시스템을 등록 해제할 수 있습니다.

절차

- 시스템에 로그인합니다.

- 창 왼쪽 상단에서 활동 을 클릭합니다.

- 메뉴 옵션에서 애플리케이션 표시 아이콘을 클릭합니다.

- Red Hat Subscription Manager 아이콘을 클릭하거나 검색에 Red Hat Subscription Manager 를 입력합니다.

Authentication Required 대화 상자에 관리자 암호를 입력합니다. 서브스크립션 창이 표시되고 서브스크립션, 시스템 용도 및 설치된 제품의 현재 상태가 표시됩니다. 등록되지 않은 제품에는 빨간색 X가 표시됩니다.

시스템에서 권한 있는 작업을 수행하려면 인증이 필요합니다.

- 취소 버튼을 클릭합니다.

시스템은 서브스크립션 관리 서버에서 등록 취소되며 '시스템이 현재 등록되지 않은 상태' 상태는 버튼이 활성화된 상태로 표시됩니다.

중단되지 않는 서비스를 계속하려면 시스템을 관리 서비스 중 하나로 다시 등록합니다. 시스템을 관리 서비스에 등록하지 않으면 시스템 업데이트를 받지 못할 수 있습니다. 시스템 등록에 대한 자세한 내용은 서브스크립션 관리자 사용자 인터페이스를 사용하여 시스템 등록을 참조하십시오.

7.2. Satellite 서버에서 등록 해제

Satellite Server에서 Red Hat Enterprise Linux 시스템의 등록을 취소하려면 Satellite 서버에서 시스템을 제거합니다.

자세한 내용은 Red Hat Satellite에서 호스트 제거를 참조하십시오.

8장. RHEL 베타 릴리스를 설치하고 부팅하기 위해 UEFI Secure Boot가 활성화된 시스템 준비

운영 체제의 보안을 강화하려면 UEFI Secure Boot가 활성화된 시스템에서 Red Hat Enterprise Linux 베타 릴리스를 부팅할 때 UEFI Secure Boot 기능을 사용하여 서명 확인을 수행합니다.

8.1. UEFI Secure Boot 및 RHEL Beta 릴리스

UEFI Secure Boot를 사용하려면 운영 체제 커널이 인식된 개인 키로 서명해야 합니다. UEFI Secure Boot는 해당 공개 키를 사용하여 서명을 확인합니다.

Red Hat Enterprise Linux 베타 릴리스의 경우 커널은 Red Hat 베타 고유의 개인 키로 서명됩니다. UEFI Secure Boot는 해당 공개 키를 사용하여 서명을 확인하려고 하지만 하드웨어가 베타 개인 키를 인식하지 않기 때문에 Red Hat Enterprise Linux Beta 릴리스 시스템이 부팅되지 않습니다. 따라서 베타 릴리스와 함께 UEFI Secure Boot를 사용하려면 MOK(Machine Owner Key) 기능을 사용하여 시스템에 Red Hat 베타 공개 키를 추가합니다.

8.2. UEFI Secure Boot의 베타 공개 키 추가

이 섹션에서는 UEFI Secure Boot를 위한 Red Hat Enterprise Linux 베타 공개 키를 추가하는 방법에 대해 설명합니다.

사전 요구 사항

- 시스템에서 UEFI Secure Boot가 비활성화되어 있습니다.

- Red Hat Enterprise Linux 베타 릴리스가 설치되고 시스템 재부팅 후에도 Secure Boot가 비활성화됩니다.