构建应用程序

在 OpenShift Container Platform 中创建和管理应用程序

摘要

第 1 章 构建应用程序概述

使用 OpenShift Container Platform,您可以使用 Web 控制台或命令行界面 (CLI) 创建、编辑、删除和管理应用程序。

1.1. 使用项目

通过使用项目,您可以以隔离方式组织和管理应用程序。您可以在 OpenShift Container Platform 中管理整个项目生命周期,包括创建、查看和删除项目。

在创建项目后,您可以使用 Developer 视角 授予或撤销对项目的访问权限,并为用户管理集群角色。您还可以在创建用于自动置备新项目的项目模板时编辑项目配置资源。

使用 CLI,您可以通过模拟对 OpenShift Container Platform API 的请求来以不同的用户创建项目。当您请求创建新项目时,OpenShift Container Platform 会使用一个端点来根据自定义模板来置备项目。作为集群管理员,您可以选择阻止经过身份验证的用户组自助置备新项目。

1.2. 处理应用程序

1.2.1. 创建应用程序

要创建应用程序,您必须已创建了一个项目,或者具有适当的角色和权限访问一个项目。您可以通过 web 控制台的开发者视角, 安装的 Operator, 或 OpenShift Container Platform CLI 来创建一个应用程序。您可以从 Git、JAR 文件、devfile 或开发人员目录中提供要添加到项目的应用程序。

您还可以使用包含源或二进制代码、镜像和模板的组件,通过 OpenShift Container Platform CLI 创建应用程序。使用 OpenShift Container Platform Web 控制台,您可以从集群管理员安装的 Operator 创建应用程序。

1.2.2. 维护应用程序

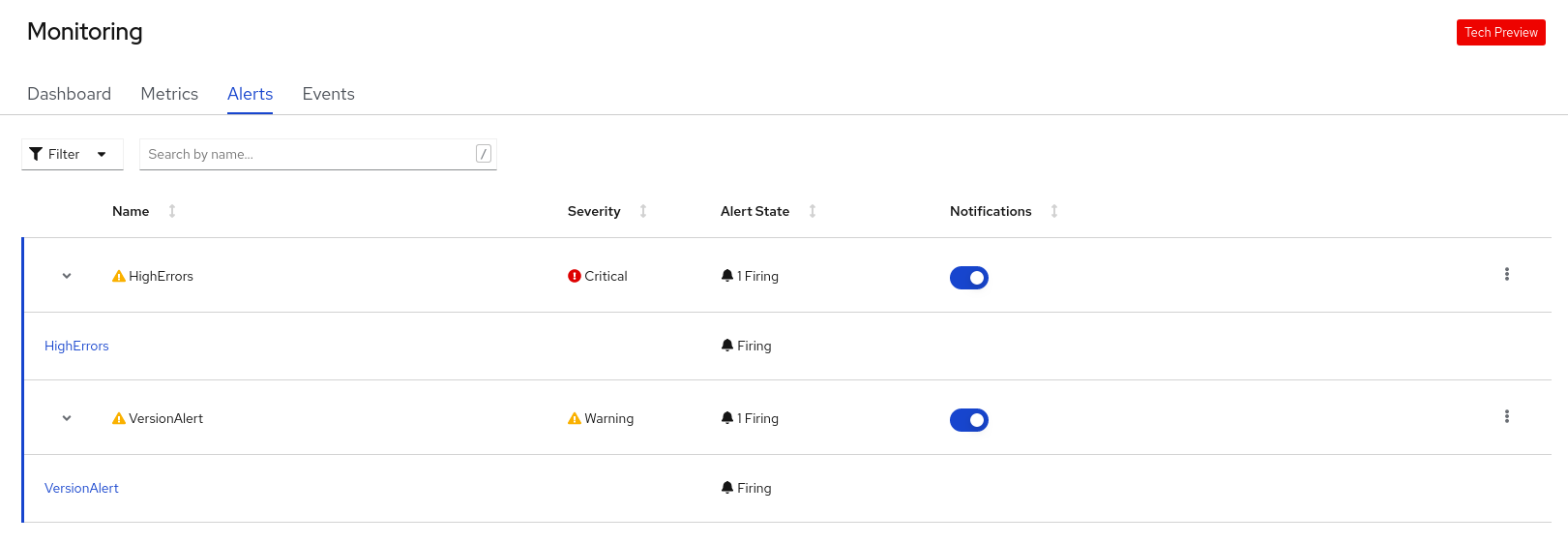

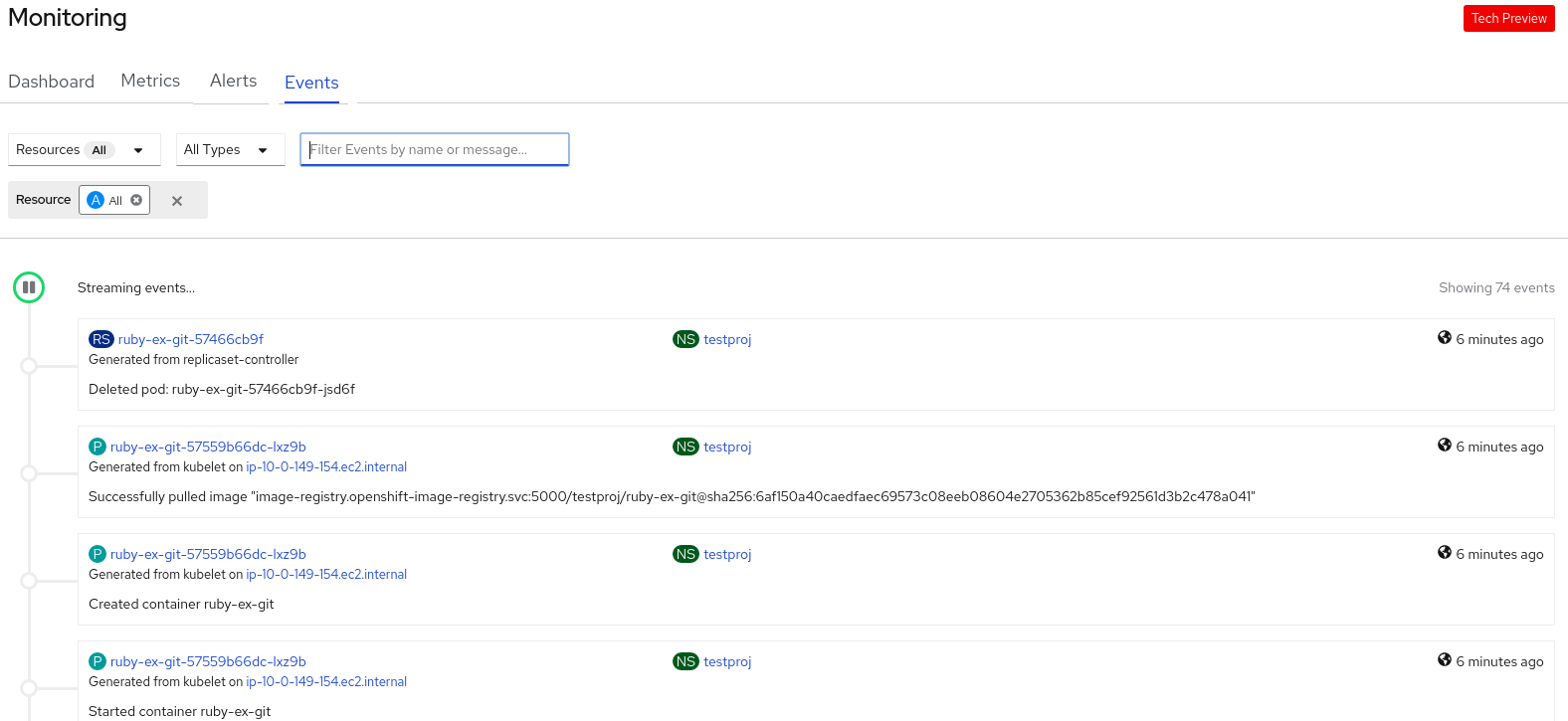

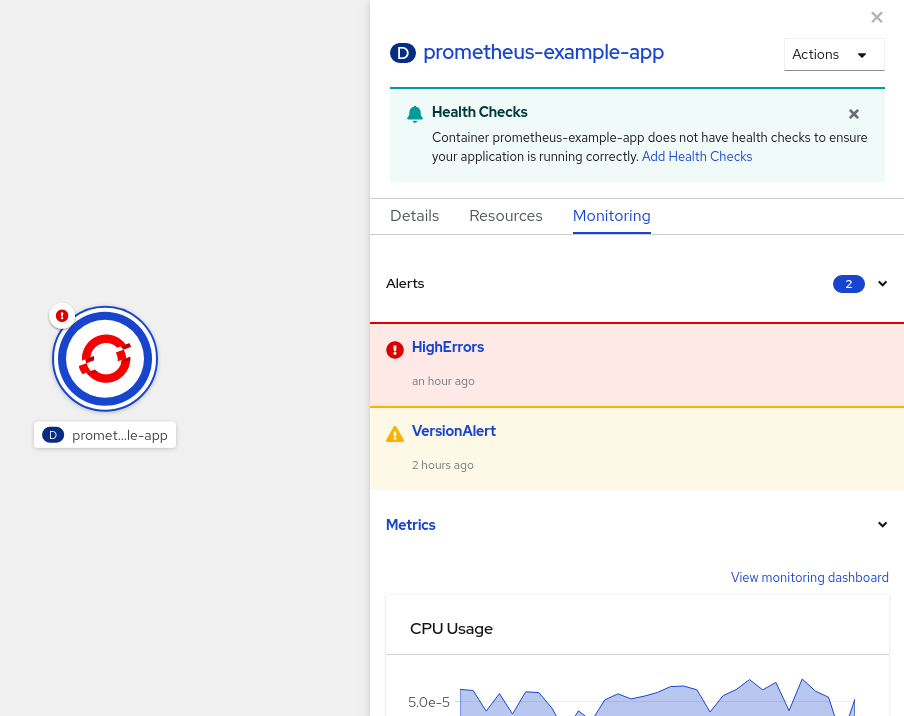

创建应用程序后,您可以使用 Web 控制台监控项目或应用指标。您还可以使用 Web 控制台 编辑或删除应用程序。当应用程序运行时,并非所有应用资源都不会被使用。作为集群管理员,您可以选择闲置这些可扩展资源来减少资源消耗。

1.2.3. 将应用程序连接到服务

应用程序使用后端服务来构建和连接工作负载,这因服务提供商而异。使用 Service Binding Operator 作为开发人员,您可以将工作负载与 Operator 管理的后端服务绑定在一起,而无需手动步骤配置绑定连接。您还可以在 IBM Power Systems、IBM Z 和 LinuxONE 环境中应用服务绑定。

1.2.4. 部署应用程序

您可以使用 Deployment 或 DeploymentConfig 对象部署应用程序,并从 Web 控制台管理应用程序。您可以创建部署策略,以帮助减少更改期间或升级到应用程序的停机时间。

您还可以使用 Helm,它是一个软件包管理器,简化了应用程序和服务部署到 OpenShift Container Platform 集群的过程。

1.3. 使用 Red Hat Marketplace

Red Hat Marketplace 是一个开源云市场,您可以在其中发现并访问在公共云和内部运行的基于容器的环境的认证软件。

第 2 章 项目

2.1. 处理项目

通过项目(project),一个社区用户可以在与其他社区隔离的前提下组织和管理其内容。

以 openshift- 和 kube- 开始的项目是默认项目。这些项目托管作为 pod 运行的主要组件和其他基础架构组件。因此,OpenShift Container Platform 不允许使用 oc new-project 命令创建以 openshift- 或 kube- 开始的项目。集群管理员可以使用 oc adm new-project 命令创建这些项目。

您无法将 SCC 分配给在以下某一默认命名空间中创建的 Pod: default、kube-system、kube-public、openshift-node、openshift-infra、openshift。您不能使用这些命名空间用来运行 pod 或服务。

2.1.1. 使用 Web 控制台创建项目

如果集群管理员允许,您可以创建新项目。

OpenShift Container Platform 认为以 openshift- 和 kube- 开头的项目是重要的。因此,OpenShift Container Platform 不允许使用 web 控制台创建以 openshift- 开头的项目。

您无法将 SCC 分配给在以下某一默认命名空间中创建的 Pod: default、kube-system、kube-public、openshift-node、openshift-infra、openshift。您不能使用这些命名空间用来运行 pod 或服务。

流程

- 浏览至 Home → Project。

- 点击 Create Project。

- 输入项目详情。

- 点击 Create。

2.1.2. 在 Web 控制台中使用 Developer 视角创建项目

您可以使用 OpenShift Container Platform Web 控制台中的 Developer 视角在集群中创建项目。

OpenShift Container Platform 认为以 openshift- 和 kube- 开头的项目是重要的。因此,OpenShift Container Platform 不允许使用 Developer 视角创建以 openshift- 或 kube- 开头的项目。集群管理员可以使用 oc adm new-project 命令创建这些项目。

您无法将 SCC 分配给在以下某一默认命名空间中创建的 Pod: default、kube-system、kube-public、openshift-node、openshift-infra、openshift。您不能使用这些命名空间用来运行 pod 或服务。

先决条件

- 在 OpenShift Container Platform 中,确保您有适当的角色和权限来创建项目、应用程序和其他工作负载。

流程

您可以使用 Developer 视角创建项目,如下所示:

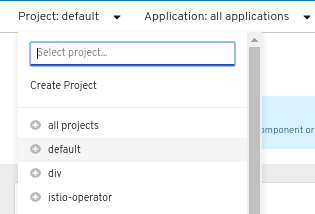

点 Project 下拉菜单来查看所有可用的项目。选择 Create Project。

图 2.1. Create Project

-

在 Create Project 对话框的 Name 项中输入一个唯一的名称,如

myproject。 - 可选:为项目添加 Display Name 和 Description 详情。

- 点击 Create。

- 使用左侧导航面板导航到 Project 视图,在仪表板中查看您的项目。

可选:

- 在屏幕顶部的 Project 下拉菜单中选择 all projects 列出集群中的所有项目。

- 使用 Details 选项卡查看项目详情。

- 如果您有足够的项目权限,可以使用 Project Access 选项卡为项目提供或撤销 administrator、edit 和 view 权限。

2.1.3. 使用 CLI 创建项目

如果集群管理员允许,您可以创建新项目。

OpenShift Container Platform 认为以 openshift- 和 kube- 开头的项目是重要的。因此,OpenShift Container Platform 不允许使用 oc new-project 命令创建以 openshift- 或 kube- 开始的项目。集群管理员可以使用 oc adm new-project 命令创建这些项目。

您无法将 SCC 分配给在以下某一默认命名空间中创建的 Pod: default、kube-system、kube-public、openshift-node、openshift-infra、openshift。您不能使用这些命名空间用来运行 pod 或服务。

流程

运行:

$ oc new-project <project_name> \ --description="<description>" --display-name="<display_name>"例如:

$ oc new-project hello-openshift \ --description="This is an example project" \ --display-name="Hello OpenShift"

系统管理员可能会限制允许创建的项目数量。达到限值后,需要删除现有项目才能创建新项目。

2.1.4. 使用 Web 控制台查看项目

流程

- 浏览至 Home → Project。

选择要查看的项目。

在本页中,点击 Workloads 以查看项目中的工作负载。

2.1.5. 使用 CLI 查看项目

查看项目时,只能看到根据授权策略您有权访问的项目。

流程

要查看项目列表,请运行:

$ oc get projects您可以从当前项目更改到其他项目,以进行 CLI 操作。然后,所有操控项目范围内容的后续操作都会使用指定的项目:

$ oc project <project_name>

2.1.6. 使用 Developer 视角为您的项目提供访问权限

您可以使用 Developer 视角中的 Project 视图来授予或撤销对项目的访问权限。

流程

将用户添加到项目,并为用户提供 Admin、Edit 或 View 访问权限:

- 在 Developer 视角中,导航到 Project 视图。

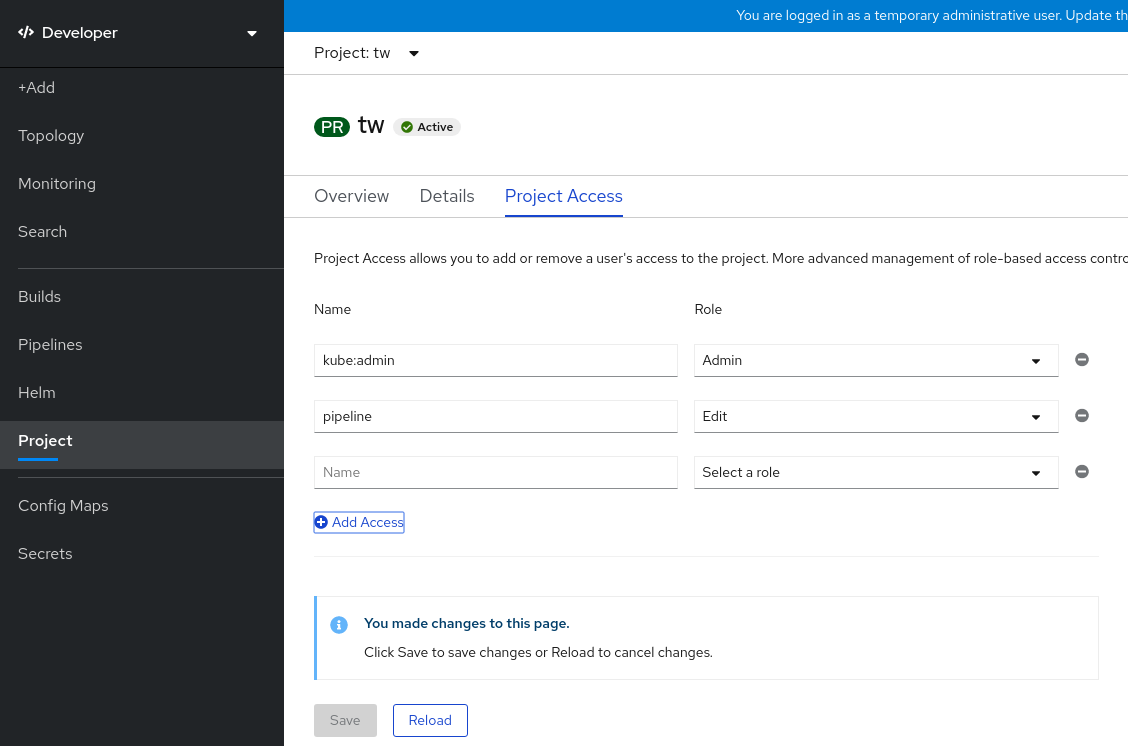

- 在 Project 页面中,选择 Project Access 选项卡。

点击 Add Access 为默认权限添加新权限行。

图 2.2. 项目权限

- 输入用户名,点 Select a role 下拉列表,然后选择适当的角色。

- 点击 Save 添加新权限。

您还可以使用:

- Select a role 下拉列表修改现有用户的访问权限。

- Remove Access 图标以完全删除现有用户对项目的访问权限。

基于角色的高级访问控制是在 Administrator 视角的 Roles 和 Roles Binding 视图中管理的。

2.1.7. 使用 Developer 视角自定义可用的集群角色

项目的用户根据其访问控制分配到集群角色。您可以通过导航到 Project → Project access → Role 来访问这些集群角色。默认情况下,这些角色为 Admin、Edit 和 View。

要为项目添加或编辑集群角色,您可以自定义集群的 YAML 代码。

流程

自定义项目的不同集群角色:

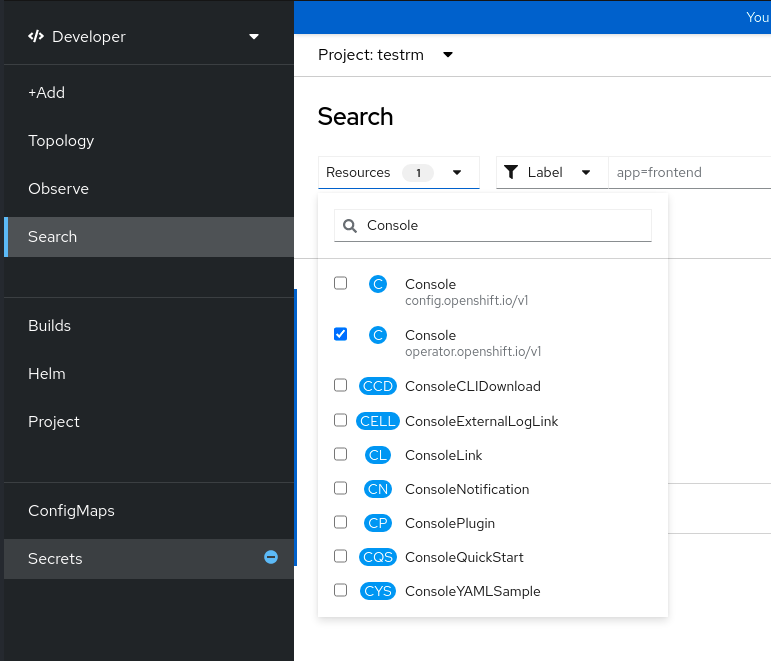

-

在 Search 视图中,使用 Resources 下拉列表搜索

Console。 在可用选项中,选择 Console

operator.openshift.io/v1。图 2.3. 搜索控制台资源

- 在 Name 列表下选择 cluster。

- 导航到 YAML 选项卡以查看和编辑 YAML 代码。

在

spec下的 YAML 代码中,添加或编辑availableClusterRoles列表并保存您的更改:spec: customization: projectAccess: availableClusterRoles: - admin - edit - view

2.1.8. 添加到项目

流程

- 在 Web 控制台导航菜单顶部的上下文选择器中,选择 Developer。

- 点击 + Add

- 在页面顶部,选择要添加到的项目的名称。

- 单击添加到项目的方法,然后按照工作流操作。

您还可以使用快速搜索在拓扑中添加组件。

2.1.9. 使用 Web 控制台检查项目状态

流程

- 浏览至 Home → Project。

- 选择一个项目来查看其状态。

2.1.10. 使用 CLI 检查项目状态

流程

运行:

$ oc status此命令提供当前项目的高级概述,以及它的组件和关系。

2.1.11. 使用 web 控制台删除项目

您可以通过 OpenShift Container Platform Web 控制台删除一个项目。

如果您没有删除项目的权限,Delete Project 选项将无法使用。

流程

- 浏览至 Home → Project。

- 找到您要从项目列表中删除的项目。

-

在项目列表的最右侧,从 Options 菜单中

选择 Delete Project。

选择 Delete Project。

- 打开 Delete Project 界面时,在字段中输入要删除的项目名称。

- 点击 Delete。

2.1.12. 使用 CLI 删除项目

当您删除项目时,服务器会将项目状态从 Active 更新为 Terminating。在最终移除项目前,服务器会清除处于 Terminating 状态的项目中的所有内容。项目处于 Terminating 状态时,您无法将新的内容添加到这个项目中。可以从 CLI 或 Web 控制台删除项目。

流程

运行:

$ oc delete project <project_name>

2.2. 以其他用户身份创建项目

通过身份模拟功能,您可以其他用户的身份创建项目。

2.2.1. API 身份模拟(impersonation)

您可以配置对 OpenShift Container Platform API 的请求,使其表现为像是源自于另一用户。如需更多信息,请参阅 Kubernetes 文档中的用户身份模拟。

2.2.2. 在创建项目时模拟用户

您可在创建项目请求时模拟其他用户。由于 system:authenticated:oauth 是唯一能够创建项目请求的 bootstrap 组,因此您必须模拟这个组。

流程

代表其他用户创建项目请求:

$ oc new-project <project> --as=<user> \ --as-group=system:authenticated --as-group=system:authenticated:oauth

2.3. 配置项目创建

在 OpenShift Container Platform 中,项目用于对相关对象进行分组和隔离。使用 Web 控制台或 oc new-project 命令请求创建新项目时,系统会根据可自定义的模板来使用 OpenShift Container Platform 中的端点置备项目。

作为集群管理员,您可以允许开发人员和服务帐户创建或自助置备其自己的项目,并且配置具体的方式。

2.3.1. 关于项目创建

OpenShift Container Platform API 服务器根据项目模板自动置备新的项目,模板通过集群的项目配置资源中的 projectRequestTemplate 参数来标识。如果没有定义该参数,API 服务器会创建一个默认模板,该模板将以请求的名称创建项目,并将请求用户分配至该项目的 admin 角色。

提交项目请求时,API 会替换模板中的以下参数:

| 参数 | 描述 |

|---|---|

|

| 项目的名称。必需。 |

|

| 项目的显示名称。可以为空。 |

|

| 项目的描述。可以为空。 |

|

| 管理用户的用户名。 |

|

| 请求用户的用户名。 |

API 访问权限将授予具有 self-provisioner 角色和 self-provisioners 集群角色绑定的开发人员。默认情况下,所有通过身份验证的开发人员都可获得此角色。

2.3.2. 为新项目修改模板

作为集群管理员,您可以修改默认项目模板,以便使用自定义要求创建新项目。

创建自己的自定义项目模板:

流程

-

以具有

cluster-admin特权的用户身份登录。 生成默认项目模板:

$ oc adm create-bootstrap-project-template -o yaml > template.yaml-

使用文本编辑器,通过添加对象或修改现有对象来修改生成的

template.yaml文件。 项目模板必须创建在

openshift-config命名空间中。加载修改后的模板:$ oc create -f template.yaml -n openshift-config使用 Web 控制台或 CLI 编辑项目配置资源。

使用 Web 控制台:

- 导航至 Administration → Cluster Settings 页面。

- 单击 Configuration 以查看所有配置资源。

- 找到 Project 的条目,并点击 Edit YAML。

使用 CLI:

编辑

project.config.openshift.io/cluster资源:$ oc edit project.config.openshift.io/cluster

更新

spec部分,使其包含projectRequestTemplate和name参数,再设置您上传的项目模板的名称。默认名称为project-request。带有自定义项目模板的项目配置资源

apiVersion: config.openshift.io/v1 kind: Project metadata: ... spec: projectRequestTemplate: name: <template_name>- 保存更改后,创建一个新项目来验证是否成功应用了您的更改。

2.3.3. 禁用项目自助置备

您可以防止经过身份验证的用户组自助置备新项目。

流程

-

以具有

cluster-admin特权的用户身份登录。 运行以下命令,以查看

self-provisioners集群角色绑定用法:$ oc describe clusterrolebinding.rbac self-provisioners输出示例

Name: self-provisioners Labels: <none> Annotations: rbac.authorization.kubernetes.io/autoupdate=true Role: Kind: ClusterRole Name: self-provisioner Subjects: Kind Name Namespace ---- ---- --------- Group system:authenticated:oauth检查

self-provisioners部分中的主题。从

system:authenticated:oauth组中移除self-provisioner集群角色。如果

self-provisioners集群角色绑定仅将self-provisioner角色绑定至system:authenticated:oauth组,请运行以下命令:$ oc patch clusterrolebinding.rbac self-provisioners -p '{"subjects": null}'如果

self-provisioners集群角色将self-provisioner角色绑定到system:authenticated:oauth组以外的多个用户、组或服务帐户,请运行以下命令:$ oc adm policy \ remove-cluster-role-from-group self-provisioner \ system:authenticated:oauth

编辑

self-provisioners集群角色绑定,以防止自动更新角色。自动更新会使集群角色重置为默认状态。使用 CLI 更新角色绑定:

运行以下命令:

$ oc edit clusterrolebinding.rbac self-provisioners在显示的角色绑定中,将

rbac.authorization.kubernetes.io/autoupdate参数值设置为false,如下例所示:apiVersion: authorization.openshift.io/v1 kind: ClusterRoleBinding metadata: annotations: rbac.authorization.kubernetes.io/autoupdate: "false" ...

使用单个命令更新角色绑定:

$ oc patch clusterrolebinding.rbac self-provisioners -p '{ "metadata": { "annotations": { "rbac.authorization.kubernetes.io/autoupdate": "false" } } }'

以通过身份验证的用户身份登陆,验证是否无法再自助置备项目:

$ oc new-project test输出示例

Error from server (Forbidden): You may not request a new project via this API.您可以对此项目请求消息进行自定义,以提供特定于您的组织的更多有用说明。

2.3.4. 自定义项目请求消息

当无法自助置备项目的开发人员或服务帐户使用 Web 控制台或 CLI 提出项目创建请求时,默认返回以下错误消息:

You may not request a new project via this API.集群管理员可以自定义此消息。您可以对这个消息进行自定义,以提供特定于您的组织的关于如何请求新项目的信息。例如:

-

To request a project, contact your system administrator at

projectname@example.com. -

To request a new project, fill out the project request form located at

https://internal.example.com/openshift-project-request.

自定义项目请求消息:

流程

使用 Web 控制台或 CLI 编辑项目配置资源。

使用 Web 控制台:

- 导航至 Administration → Cluster Settings 页面。

- 单击 Configuration 以查看所有配置资源。

- 找到 Project 的条目,并点击 Edit YAML。

使用 CLI:

-

以具有

cluster-admin特权的用户身份登录。 编辑

project.config.openshift.io/cluster资源:$ oc edit project.config.openshift.io/cluster

-

以具有

更新

spec部分,使其包含projectRequestMessage参数,并将值设为您的自定义消息:带有自定义项目请求消息的项目配置资源

apiVersion: config.openshift.io/v1 kind: Project metadata: ... spec: projectRequestMessage: <message_string>例如:

apiVersion: config.openshift.io/v1 kind: Project metadata: ... spec: projectRequestMessage: To request a project, contact your system administrator at projectname@example.com.- 保存更改后,请尝试用无法自助置备项目的开发人员或服务帐户创建一个新项目,以验证是否成功应用了您的更改。

第 3 章 创建应用程序

3.1. 使用 Developer 视角创建应用程序

Web 控制台中的 Developer 视角为您提供了下列选项,以便您从 +Add 视图中创建应用程序和相关服务,并将它们部署到 OpenShift Container Platform:

入门资源:使用这些资源帮助您开始使用开发人员控制台。您可以选择使用 Options 菜单

来隐藏标头。

来隐藏标头。

- 使用示例创建应用程序:使用现有代码示例开始在 OpenShift Container Platform 上创建应用程序。

- 使用引导式练习文档构建:遵循指导文档构建应用并熟悉关键概念和术语。

- 探索开发人员新功能:探索 Developer 视角中的新功能和资源。

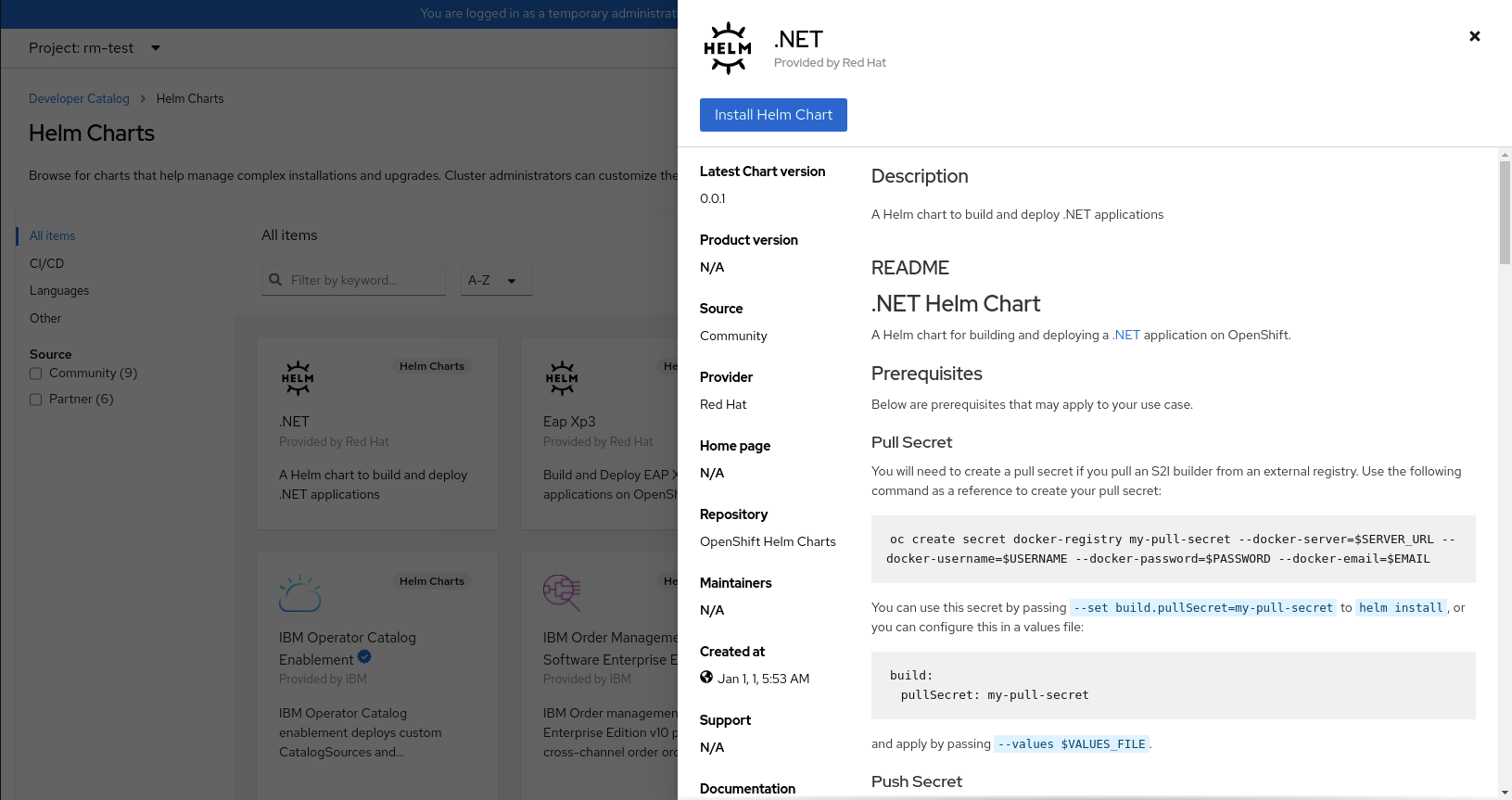

Developer Catalog:浏览 Developer Catalog 以选择所需的应用、服务或源到镜像构建器,然后将它添加到项目中。

- 所有服务:浏览目录以在 OpenShift Container Platform 中发现服务。

- Database:选择所需的数据库服务并将其添加到应用程序中。

- Operator Backed:选择和部署所需的 Operator 管理服务。

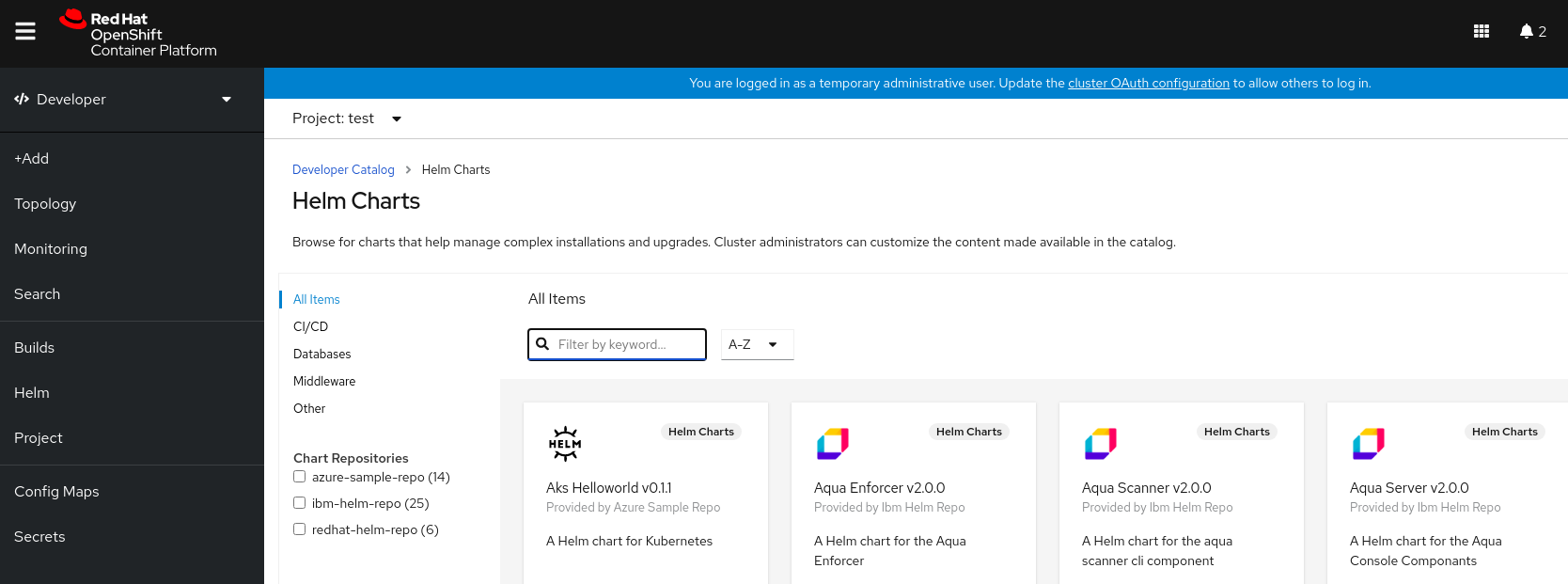

- Helm Chart:选择所需的 Helm Chart 来简化应用程序和服务部署。

Event Source:选择一个事件源,从特定系统中注册对一类事件的兴趣。

注意如果安装了 RHOAS Operator,也可使用 Managed services 选项。

- Git 存储库:使用 From Git、From Devfile 或 From Dockerfile 选项分别从您的 Git 存储库中导入一个存在的 codebase、Devfile 或 Dockerfile,以在 OpenShift Container Platform 上构建和部署一个应用程序。

- Container Image:使用镜像流或 registry 中的现有镜像,将其部署到 OpenShift Container Platform 中。

- Pipelines:使用 Tekton 管道为 OpenShift Container Platform 上的软件交付过程创建 CI/CD 管道。

Serverless:探索 Serverless 选项,在 OpenShift Container Platform 中创建、构建和部署无状态和无服务器应用程序。

- Channel:创建一个 Knative 频道以创建一个事件转发,使用内存的持久性层以及可靠的实现

- 示例:探索可用的示例应用程序,以快速创建、构建和部署应用程序。

From Local Machine:通过 From Local Machine 标题导入或上传在您的本地机器中的文件用于更方便地构建并部署应用程序。

- 导入 YAML:上传 YAML 文件,以创建并定义用于构建和部署应用程序的资源。

- 上传 JAR 文件:上传 JAR 文件以构建和部署 Java 应用。

请注意,特定的选项,如 Pipelines、Event Source 和 Import Virtual Machines 只在 OpenShift Pipelines Operator、OpenShift Serverless Operator 和 OpenShift Virtualization Operator 被安装时才会显示。

3.1.1. 先决条件

要使用 Developer 视角创建应用程序,请确认以下几项:

- 已登陆到 web 控制台。

- 您已创建了一个项目,或者具有适当的角色和权限访问项目,以便在 OpenShift Container Platform 中创建应用程序和其他工作负载。

除以上所要求外,要创建无服务器应用程序,请确保:

3.1.2. 创建抽样应用程序

您可以使用 Developer 视角的 +Add 流中的基本示例应用程序来快速创建、构建和部署应用程序。

以下流程解释了 Developer 视角中的 Samples 选项以创建示例应用程序。

流程

- 在 +Add 视图中,点 Samples 标题查看 Samples 页面。

- 在 Samples 页面中,选择一个可用的示例应用程序来查看 Create Sample Application 表单。

在 Create Sample Application Form 中:

- 在 Name 字段中,部署名称会被默认显示。您可以根据需要修改此名称。

- 在 Builder Image Version 中,会默认选择一个构建器镜像。您可以使用 Builder Image Version 下拉列表修改此镜像版本。

- 默认添加 Git 存储库 URL 示例。

- 点 Create 创建示例应用程序。示例应用程序的构建状态显示在 Topology 视图中。创建示例应用程序后,您可以看到添加到应用程序的部署。

3.1.3. 从 Git 导入代码库来创建应用程序

您可以在 Developer 视角中,使用 GitHub 中的现有代码库,在 OpenShift Container Platform 中创建、构建和部署应用程序。

以下流程逐步指导您在 Developer 视角中使用 Import from Git 选项来创建应用程序。

流程

- 在 +Add 视图中,点 Git Repository 标题中的 From Git 来查看 Import from git 表单。

-

在 Git 部分中,输入您要用来创建应用程序的代码库的 Git 存储库 URL。例如,输入此示例 Node.js 应用程序的 URL

https://github.com/sclorg/nodejs-ex。这个 URL 随后会被验证。 可选:点 Show Advanced Git Options 来添加详情,例如:

- git Reference,指向特定的分支、标签或提交中的代码,以用于构建应用程序。

- Context Dir,指定要用来构建应用程序的应用程序源代码的子目录。

- Source Secret,创建一个具有用来从私有存储库拉取源代码的凭证的 Secret Name。

可选:您可以通过 Git 存储库导入 devfile、Dockerfile 或构建器镜像来进一步自定义部署。

- 如果您的 Git 存储库包含 devfile、Dockerfile 或构建器镜像,它会被自动检测并填充到相应的路径字段中。如果同一存储库中检测到 devfile、Dockerfile 和构建器镜像,则默认选择 devfile。

- 若要编辑文件导入类型并选择不同的策略,请单击 Edit import strategy 选项。

- 如果检测到多个 devfile、Dockerfile 或构建器镜像,以导入特定的 devfile、Dockerfile 或构建器镜像,请指定与上下文目录相关的相应路径。

在验证 Git URL 后,会选择建议的构建器镜像并标记为星号。如果构建器镜像没有自动探测到,请选择一个构建器镜像。对于

https://github.com/sclorg/nodejs-exGit URL,默认选择了 Node.js 构建器镜像。- 可选: 使用 Builder Image Version 下拉菜单指定版本。

- 可选: 使用 Edit import 策略来选择不同的策略。

在 General 部分中:

-

在 Application 字段中输入应用程序组别的唯一名称,例如

myapp。确保应用程序名称在命名空间中具有唯一性。 系统会基于 Git 存储库的 URL 自动填充 Name 字段,以标识为此应用程序创建的资源(如果没有存在的应用程序)。如果已有应用程序,可以选择将组件部署到现有应用程序中,创建一个新应用程序,或保持该组件没有被分配。

注意资源名称必须在命名空间中具有唯一性。如果遇到错误,请修改资源名称。

-

在 Application 字段中输入应用程序组别的唯一名称,例如

在 Resources 部分,选择:

- Deployment,以纯 Kubernetes 风格方式创建应用程序。

- Deployment Config,创建 OpenShift Container Platform 风格的应用程序。

Serverless Deployment,创建 Knative 服务。

注意只有集群中安装 OpenShift Serverless Operator 时,Import from git 表单中才会显示 Serverless Deployment 选项。如需了解更多详细信息,请参阅 OpenShift Serverless 文档。

- 在 Pipelines 部分,选择 Add Pipeline,然后点 Show Pipeline Visualization 来查看应用程序的管道。

- Advanced Options 部分中默认选中 Create a route to the application,以便您可以使用公开的 URL 访问应用程序。如果不想通过公共路由公开您的应用程序,可以清除此复选框。

- 可选:可以使用以下高级选项进一步自定义应用程序:

- 路由

点击 Routing 链接,您可以执行以下操作:

- 自定义路由的主机名。

- 指定路由器监控的路径。

- 从下拉列表中选择流量的目标端口。

选中 Secure Route 复选框来保护您的路由。从相应的下拉列表中,选择所需的 TLS 终止类型,并设置非安全流量的策略。

注意对于无服务器应用程序,Knative 服务管理上述所有路由选项。但在需要时,您可以自定义流量的目标端口。如果不指定目标端口,则使用默认端口

8080。

- 域映射

如果要创建 Serverless Deployment,您可以在创建过程中添加自定义域映射到 Knative 服务。

在 Advanced options 部分中,点 Show advanced Routing options。

- 如果要映射到该服务的域映射 CR 已存在,您可以从 Domain mapping 下拉菜单中选择它。

-

如果要创建新域映射 CR,在框中输入域名,然后选择 Create 选项。例如,如果您在

example.com 中键入,则 Create 选项为 Create "example.com"。

- 健康检查

点击 Health Checks 链接为您的应用程序添加就绪(Readiness)、存活(Liveness)和启动(Startup)探测。所有探测都预先填充默认数据; 您可以使用默认数据添加探测或根据需要进行自定义。

自定义健康探测:

- 点 Add Readiness Probe,在需要的情况下修改参数来检查容器是否准备好处理请求,然后选择要添加的探测。

- 点 Add Liveness Probe,在需要的情况下修改参数来检查容器是否仍在运行,选择要添加的探测。

点 Add Startup Probe,在需要的情况下修改参数来检查容器内的应用程序是否已启动,选择要添加的探测。

对于每个探测,您可以从下拉列表中指定请求类型 - HTTP GET、Container Command 或 TCP Socket。表单会根据所选请求类型进行更改。然后您可以修改其它参数的默认值,如探测成功和失败的阈值、在容器启动后执行第一个探测前的秒数、探测的频率以及超时值。

- 构建配置和部署

点 Build Configuration 和 Deployment Configuration 链接来查看对应的配置选项。一些选项会被默认选中;您可以通过添加必要的触发器和环境变量来进一步自定义。

对于无服务器应用程序,Deployment 选项不会显示,因为 Knative 配置资源为您的部署维护所需的状态,而不是由

DeploymentConfig资源来维护。

- 扩展

点击 Scaling 链接,以定义您要初始部署的应用程序的 pod 数或实例数。

如果要创建无服务器部署,也可以配置以下设置:

-

最小 Pod 决定 Knative 服务在任意给定时间运行的 pod 数量较低限制。这也被称为

minScale设置。 -

最大 Pod 决定了 Knative 服务可在任意给定时间运行的 pod 数量上限。这也被称为

maxScale设置。 - 并发目标 决定了给定时间每个应用程序实例所需的并发请求数。

- 并发限制 决定了给定时间允许每个应用程序的并发请求数的限值。

- 并发利用率 决定了在 Knative 扩展额外 pod 前必须满足并发请求限制的百分比,以处理额外的流量。

-

自动扩展窗口定义了平均时间窗口,以便在自动扩展器不处于 panic 模式时提供缩放决策的输入。如果在此窗口中没有收到任何请求,服务将缩减为零。autoscale 窗口的默认持续时间为

60s。这也被称为 stable 窗口。

-

最小 Pod 决定 Knative 服务在任意给定时间运行的 pod 数量较低限制。这也被称为

- 资源限值

- 点击 Resource Limit 链接,设置容器在运行时保证或允许使用的 CPU 和 Memory 资源的数量。

- 标签

点击 Labels 链接,为您的应用程序添加自定义标签。

- 点击 Create,以创建应用程序并在 Topology 视图中查看其构建状态。

3.1.4. 上传 JAR 文件以轻松部署 Java 应用程序

您可以使用 Developer 视角的 Topology 视图中的 JAR 文件来部署 Java 应用程序。您可以使用以下选项上传 JAR 文件:

- 导航到 Developer 视角 的 +Add 视图,再单击 From Local Machine 标题中的 Upload JAR 文件。浏览并选择您的 JAR 文件,或者拖放 JAR 文件以部署您的应用。

- 进入 Topology 视图并使用 Upload JAR 文件 选项,或者拖放 JAR 文件来部署应用程序。

- 使用 Topology 视图中的 in-context 菜单,然后使用 Upload JAR 文件选项上传 JAR 文件以部署应用程序。

使用以下说明在 Topology 视图中上传 JAR 文件来部署 Java 应用程序:

流程

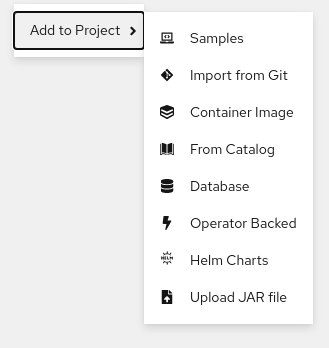

- 在 Topology 视图中,右键单击 Topology 视图中的任意位置,以查看 Add to Project 菜单。

- 将鼠标悬停在 Add to Project 菜单上,以查看菜单选项,然后选择 Upload JAR 文件选项以查看 Upload JAR 文件表单。或者,您可以在 Topology 视图中拖放 JAR 文件。

- 在 JAR 文件字段中,浏览本地计算机上所需的 JAR 文件并上传该文件。或者,您可以将 JAR 文件拖放到字段。如果将不兼容的文件类型拖放到 Topology 视图中,则右上角会显示一个警报。如果上传表单的字段中丢弃了不兼容的文件类型,则会显示字段错误。

- 您可以进一步指定可选的 Java 命令来自定义部署的应用程序。默认选择 Runtime Icon 和 Builder Image。如果没有自动探测到构建器镜像,请选择一个构建器镜像。如果需要,您可以使用 Builder Image Version 下拉列表来更改版本。

- 在可选的 Application Name 字段中输入应用程序的唯一名称作为资源标记。

- 在 Name 字段中输入唯一组件名称来命名关联的资源。

- 在 Resources 字段中,为您的应用程序选择资源类型。

- 在 Advanced options 中,点 Create a Route to the Application 配置您部署的应用程序的公共 URL。

单击 Create 以部署应用。用户会看到一个切换通知,通知 JAR 文件正在上传,这个过程会花费一段时间。相关通知还包括用于查看构建日志的链接。

注意如果用户尝试在构建运行时关闭浏览器标签页,系统会显示一个 Web 警报,询问用户是否真正想离开页面。

上传 JAR 文件并部署应用后,您可以在 Topology 视图中看到部署。

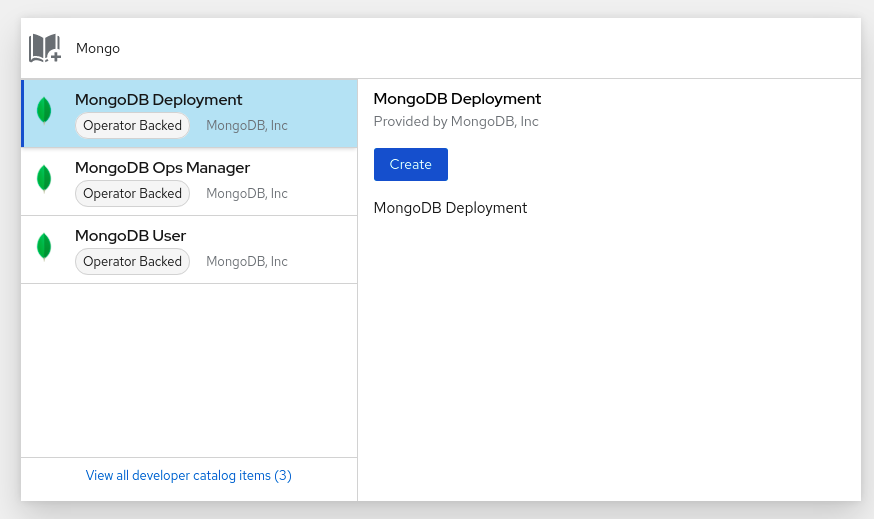

3.1.5. 使用 Developer Catalog 将服务或组件添加到应用程序中

您可以使用 Developer Catalog 根据 Operator 支持的服务(如数据库、构建器镜像和 Helm Charts)部署应用程序和服务。Developer Catalog 包含您可以添加到项目的应用程序组件、服务、事件源或 Source-to-image 构建器的集合。集群管理员可以自定义目录中提供的内容。

流程

- 在 Developer 视角中,导航到 +Add 视图,从 Developer Catalog 标题中点击 All Services 来查看 Developer Catalog 中的所有可用服务。

- 在 All Services 下,选择服务类型或您需要添加到项目的组件。在本例中,选择 Databases 以列出所有数据库服务,然后点击 MariaDB 查看该服务的详情。

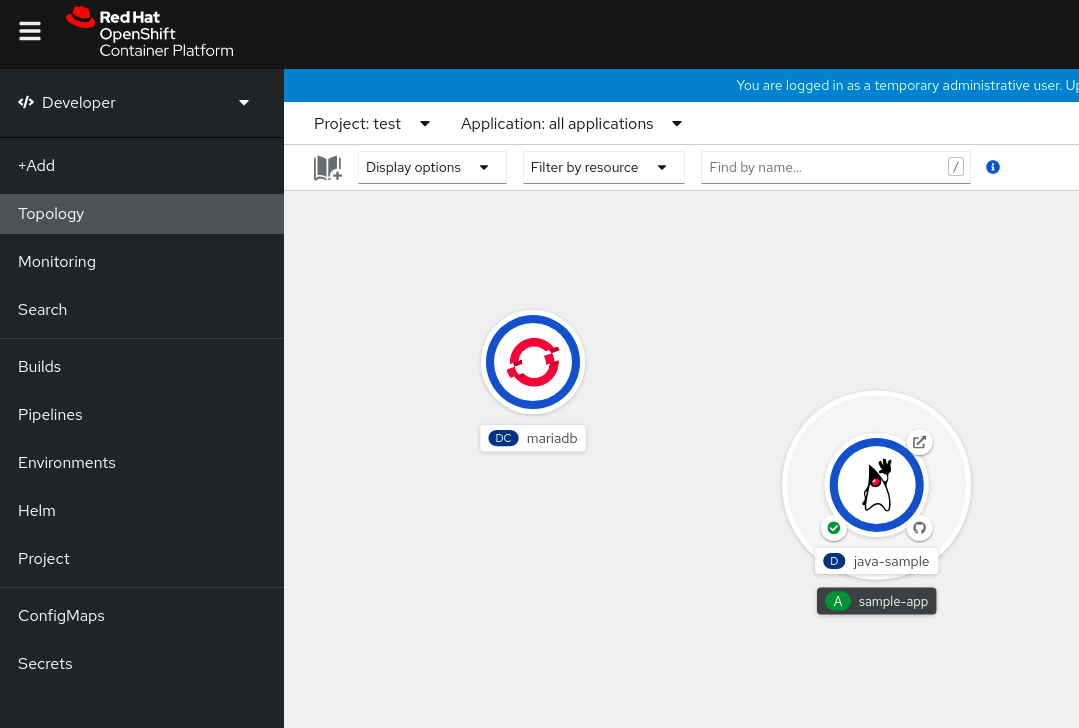

点 Instantiate Template 查看带有 MariaDB 服务详情的自动填充的模板,然后点 Create 在 Topology 视图中创建并查看 MariaDB 服务的信息。

图 3.1. Topology 中的 MariaDB

3.1.6. 其他资源

- 如需有关 OpenShift Serverless 的 Knative 路由设置的更多信息,请参阅 路由。

- 如需有关 OpenShift Serverless 的域映射设置的更多信息,请参阅为 Knative 服务配置自定义域。

- 如需有关 OpenShift Serverless 的 Knative 自动扩展设置的更多信息,请参阅 自动扩展。

- 有关向项目添加新用户的更多信息,请参阅使用项目。

3.2. 从已安装的 Operator 创建应用程序

Operators 是打包、部署和管理 Kubernetes 应用程序的方法。您可以使用集群管理员安装的 Operator 在 OpenShift Container Platform 上创建应用程序。

本指南为开发人员介绍如何使用 OpenShift Container Platform Web 控制台从已安装的 Operator 中创建应用程序。

3.2.1. 使用 Operator 创建 etcd 集群

本流程介绍了如何通过由 Operator Lifecycle Manager (OLM) 管理的 etcd Operator 来新建一个 etcd 集群。

先决条件

- 访问 OpenShift Container Platform 4.9 集群

- 管理员已在集群范围内安装了 etcd Operator。

流程

-

针对此流程在 OpenShift Container Platform Web 控制台中新建一个项目。这个示例使用名为

my-etcd的项目。 导航至 Operators → Installed Operators 页面。由集群管理员安装到集群且可供使用的 Operator 将以集群服务版本(CSV)列表形式显示在此处。CSV 用于启动和管理由 Operator 提供的软件。

提示使用以下命令从 CLI 获得该列表:

$ oc get csv在 Installed Operators 页面中,点 etcd Operator 查看更多详情和可用操作。

正如 Provided API 下所示,该 Operator 提供了三类新资源,包括一种用于 etcd Cluster 的资源(

EtcdCluster资源)。这些对象的工作方式与内置的原生 Kubernetes 对象(如Deployment或ReplicaSet)相似,但包含特定于管理 etcd 的逻辑。新建 etcd 集群:

- 在 etcd Cluster API 框中,点 Create instance。

-

在下一页上,您可对

EtcdCluster对象的最小起始模板进行任何修改,比如集群大小。现在,点击 Create 即可完成。点击后即可触发 Operator 启动 pod、服务和新 etcd 集群的其他组件。

点 example etcd 集群,然后点 Resources 选项卡,您可以看到项目现在包含很多由 Operator 自动创建和配置的资源。

验证已创建了支持您从项目中的其他 pod 访问数据库的 Kubernetes 服务。

给定项目中具有

edit角色的所有用户均可创建、管理和删除应用程序实例(本例中为 etcd 集群),这些实例由已在项目中创建的 Operator 以自助方式管理,就像云服务一样。如果要赋予其他用户这一权利,项目管理员可使用以下命令添加角色:$ oc policy add-role-to-user edit <user> -n <target_project>

现在您有了一个 etcd 集群,当 pod 运行不畅,或在集群中的节点之间迁移时,该集群将对故障做出反应并重新平衡数据。最重要的是,具有适当访问权限的集群管理员或开发人员现在可轻松将该数据库用于其应用程序。

3.3. 使用 CLI 创建应用程序

您可以使用 OpenShift Container Platform CLI,从包含源代码或二进制代码、镜像和模板的组件创建 OpenShift Container Platform 应用程序。

由 new-app 创建的对象集合取决于作为输入传递的工件,如输入源存储库、镜像或模板。

3.3.1. 从源代码创建应用程序

您可以使用 new-app 命令,从本地或远程 Git 存储库中的源代码创建应用程序。

new-app 命令会创建一个构建配置,其本身会从您的源代码中创建一个新的应用程序镜像。new-app 命令通常还会创建一个 Deployment 对象来部署新镜像,以及为运行您的镜像的部署提供负载均衡访问的服务。

OpenShift Container Platform 会自动检测要使用管道、源或 docker 构建策略,如果进行源构建,则还检测适当的语言构建器镜像。

3.3.1.1. Local

从本地目录中的 Git 存储库创建应用程序:

$ oc new-app /<path to source code>

如果使用本地 Git 存储库,该存储库必须具有一个名为 origin 的远程源,指向可由 OpenShift Container Platform 集群访问的 URL。如果没有可识别的远程源,运行 new-app 命令将创建一个二进制构建。

3.3.1.2. 远程

从远程 Git 存储库创建新应用程序:

$ oc new-app https://github.com/sclorg/cakephp-ex从私有远程 Git 存储库创建应用程序:

$ oc new-app https://github.com/youruser/yourprivaterepo --source-secret=yoursecret

如果使用私有远程 Git 存储库,您可以使用 --source-secret 标志指定一个现有源克隆 secret,此 secret 将注入到构建配置中以访问存储库。

您可以通过指定 --context-dir 标志来使用源代码存储库的子目录。从远程 Git 存储库和上下文子目录创建应用程序:

$ oc new-app https://github.com/sclorg/s2i-ruby-container.git \

--context-dir=2.0/test/puma-test-app

另外,在指定远程 URL 时,您可以通过在 URL 末尾附加 #<branch_name> 来指定要使用的 Git 分支:

$ oc new-app https://github.com/openshift/ruby-hello-world.git#beta43.3.1.3. 构建策略检测

OpenShift Container Platform 通过检测某些文件自动决定要使用的构建策略:

在创建新应用程序时,如果源存储库的根目录或指定上下文目录中存在 Jenkinsfile 文件,则 OpenShift Container Platform 会生成管道构建策略。

注意pipeline构建策略已弃用;请考虑使用 Red Hat OpenShift Pipelines。- 在创建新应用程序时,如果源存储库的根目录或指定上下文目录中存在 Dockerfile,则 OpenShift Container Platform 会生成 docker 构建策略。

- 如果没有检测到 Jenkins 文件或 Dockerfile,OpenShift Container Platform 会生成源构建策略。

通过将 --strategy 标志设置为 docker、pipeline 或 source 来覆盖自动检测到的构建策略。

$ oc new-app /home/user/code/myapp --strategy=docker

oc 命令要求包含构建源的文件在远程 Git 存储库中可用。对于所有 Source 构建,您必须使用 git remote -v。

3.3.1.4. 语言检测

如果您使用源构建策略, new-app 会尝试根据存储库根目录或指定上下文目录中是否存在特定文件来确定要使用的语言构建器:

| 语言 | 文件 |

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

检测了语言后,new-app 会在 OpenShift Container Platform 服务器上搜索具有与所检测语言匹配的 suppors 注解的镜像流标签,或与所检测语言的名称匹配的镜像流。如果找不到匹配项,new-app 会在 Docker Hub registry 中搜索名称上与所检测语言匹配的镜像。

您可以通过指定镜像(镜像流或容器规格)和存储库(以 ~ 作为分隔符),来覆盖构建器用于特定源存储库的镜像。请注意,如果进行这一操作,就不会执行构建策略检测和语言检测。

例如,使用 myproject/my-ruby 镜像流以及位于远程存储库中的源:

$ oc new-app myproject/my-ruby~https://github.com/openshift/ruby-hello-world.git

使用 openshift/ruby-20-centos7:latest 容器镜像流以及本地仓库中的源:

$ oc new-app openshift/ruby-20-centos7:latest~/home/user/code/my-ruby-app

语言检测需要在本地安装 Git 客户端,以便克隆并检查您的存储库。如果 Git 不可用,您可以使用 <image>~<repository> 语法指定要与存储库搭配使用的构建器镜像,以避免语言检测步骤。

调用 -i <image> <repository> 需要 new-app 尝试克隆 repository,从而判断其工件类型;如果 Git 不可用,此操作会失败。

调用 -i <image> --code <repository> 需要 new-app 克隆 repository,从而能判断 image 应用作源代码的构建器,还是另外部署(使用数据库镜像时)。

3.3.2. 从镜像创建应用程序

您可以从现有镜像部署应用程序。镜像可以来自 OpenShift Container Platform 服务器中的镜像流、特定 registry 中的镜像或本地 Docker 服务器中的镜像。

new-app 命令尝试确定传递给它的参数中指定的镜像类型。但是,您可以使用 --docker-image 参数明确告知 new-app 镜像是一个容器镜像,或使用 -i|--image-stream 参数明确告知镜像是一个镜像流。

如果指定本地 Docker 存储库中的镜像,必须确保同一镜像可供 OpenShift Container Platform 节点使用。

3.3.2.1. Docker Hub MySQL 镜像

从 Dockerhub MySQL 镜像创建应用程序,例如:

$ oc new-app mysql3.3.2.2. 私有 registry 中的镜像

使用私有 registry 中的镜像创建应用程序时,请指定完整容器镜像规格:

$ oc new-app myregistry:5000/example/myimage3.3.2.3. 现有镜像流和可选镜像流标签

从现有镜像流和可选镜像流标签创建应用程序:

$ oc new-app my-stream:v13.3.3. 从模板创建应用程序

您可以使用之前存储的模板或模板文件创建应用程序,方法是将模板名称指定为参数。例如,您可以存储一个示例应用程序模板,并使用它来创建应用程序。

将应用程序模板上传到当前项目的模板库。以下示例从名为 example/sample-app/application-template-stibuild.json 的文件上传一个应用程序模板:

$ oc create -f examples/sample-app/application-template-stibuild.json

然后,通过引用应用程序模板来创建新应用程序。在本例中,模板名称为 ruby-helloworld-sample:

$ oc new-app ruby-helloworld-sample

要通过引用本地文件系统中的模板文件创建新应用程序,而无需首先将其保存到 OpenShift Container Platform 中,使用 -f|--file 参数。例如:

$ oc new-app -f examples/sample-app/application-template-stibuild.json3.3.3.1. 模板参数

在基于模板创建应用程序时,请使用 -p|--param 参数来设置模板定义的参数值:

$ oc new-app ruby-helloworld-sample \

-p ADMIN_USERNAME=admin -p ADMIN_PASSWORD=mypassword

您可以将参数保存到文件中,然后在实例化模板时通过 --param-file 来使用该文件。如果要从标准输入中读取参数,请使用 --param-file=-。以下是一个名为 helloworld.params 的示例文件:

ADMIN_USERNAME=admin

ADMIN_PASSWORD=mypassword在实例化模板时引用文件中的参数:

$ oc new-app ruby-helloworld-sample --param-file=helloworld.params3.3.4. 修改应用程序创建

new-app 命令生成用于构建、部署和运行所创建应用程序的 OpenShift Container Platform 对象。通常情况下,这些对象是在当前项目中创建的,并分配有从输入源存储库或输入镜像中获得的名称。但是,您可以使用 new-app 修改这种行为。

| 对象 | 描述 |

|---|---|

|

|

为命令行中指定的每个源存储库创建一个 |

|

|

对于 |

|

|

创建一个 |

|

|

|

| 其他 | 根据模板,可在实例化模板时生成其他对象。 |

3.3.4.1. 指定环境变量

从模板、源或镜像生成应用程序时,您可以在运行时使用 -e|--env 参数将环境变量传递给应用程序容器:

$ oc new-app openshift/postgresql-92-centos7 \

-e POSTGRESQL_USER=user \

-e POSTGRESQL_DATABASE=db \

-e POSTGRESQL_PASSWORD=password

这些变量可使用 --env-file 参数从文件中读取。以下是一个名为 postgresql.env 的示例文件:

POSTGRESQL_USER=user

POSTGRESQL_DATABASE=db

POSTGRESQL_PASSWORD=password从文件中读取变量:

$ oc new-app openshift/postgresql-92-centos7 --env-file=postgresql.env

另外,也可使用 --env-file=- 在标准输入上给定环境变量:

$ cat postgresql.env | oc new-app openshift/postgresql-92-centos7 --env-file=-

在 new-app 处理过程中创建的任何 BuildConfig 对象,都不能使用通过 -e|--env 或 --env-file 参数传递的环境变量进行更新。

3.3.4.2. 指定构建环境变量

从模板、源或镜像生成应用程序时,您可以在运行时使用 --build-env 参数将环境变量传递给构建容器:

$ oc new-app openshift/ruby-23-centos7 \

--build-env HTTP_PROXY=http://myproxy.net:1337/ \

--build-env GEM_HOME=~/.gem

这些变量可使用 --build-env-file 参数从文件中读取。以下是一个名为 ruby.env 的示例文件:

HTTP_PROXY=http://myproxy.net:1337/

GEM_HOME=~/.gem从文件中读取变量:

$ oc new-app openshift/ruby-23-centos7 --build-env-file=ruby.env

另外,也可使用 --build-env-file=- 在标准输入上给定环境变量:

$ cat ruby.env | oc new-app openshift/ruby-23-centos7 --build-env-file=-3.3.4.3. 指定标签

从源、镜像或模板生成应用程序时,您可以使用 -l|--label 参数为创建的对象添加标签。借助标签,您可以轻松地集中选择、配置和删除与应用程序关联的对象。

$ oc new-app https://github.com/openshift/ruby-hello-world -l name=hello-world3.3.4.4. 查看输出但不创建

要查看运行 new-app 命令的空运行,您可以使用 -o|--output 参数及 yaml 或 json 值。然后,您可以使用输出结果预览创建的对象,或将其重定向到可以编辑的文件。满意之后,您可以使用 oc create 创建 OpenShift Container Platform 对象。

要将 new-app 工件输出到一个文件,请运行以下命令:

$ oc new-app https://github.com/openshift/ruby-hello-world \

-o yaml > myapp.yaml编辑该文件:

$ vi myapp.yaml通过引用该文件来创建新应用程序:

$ oc create -f myapp.yaml3.3.4.5. 使用其他名称创建对象

new-app 创建的对象通常命名自用于生成它们的源存储库或镜像。您可以通过在命令中添加 --name 标志来设置生成的对象名称:

$ oc new-app https://github.com/openshift/ruby-hello-world --name=myapp3.3.4.6. 在另一项目中创建对象

通常,new-app 会在当前项目中创建对象。不过,您可以使用 -n|--namespace 参数在另一项目中创建对象:

$ oc new-app https://github.com/openshift/ruby-hello-world -n myproject3.3.4.7. 创建多个对象

new-app 命令允许创建多个应用程序,为 new-app 指定多个参数便可实现。命令行中指定的标签将应用到单一命令创建的所有对象。环境变量应用到从源或镜像创建的所有组件。

从源存储库和 Docker Hub 镜像创建应用程序:

$ oc new-app https://github.com/openshift/ruby-hello-world mysql

如果以独立参数形式指定源代码存储库和构建器镜像,new-app 会将构建器镜像用作源代码存储库的构建器。如果这不是您的用意,请使用 ~ 分隔符为源指定所需的构建器镜像。

3.3.4.8. 在单个 pod 中对镜像和源进行分组

new-app 命令允许在一个 pod 中一起部署多个镜像。要指定要将哪些镜像分组在一起,使用 + 分隔符。也可使用 --group 命令行参数来指定应分组在一起的镜像。要将源存储库中构建的镜像与其他镜像一起分组,请在组中指定其构建器镜像:

$ oc new-app ruby+mysql将通过源构建的镜像和外部镜像一起部署:

$ oc new-app \

ruby~https://github.com/openshift/ruby-hello-world \

mysql \

--group=ruby+mysql3.3.4.9. 搜索镜像、模板和其他输入

要搜索镜像、模板和 oc new-app 命令的其他输入,使用 --search 和 --list。例如,查找包含 PHP 的所有镜像或模板:

$ oc new-app --search php第 4 章 使用 Topology 视图查看应用程序组成情况

Web 控制台的 Developer 视角中有一个 Topology 视图,它以可视化方式展示项目中的所有应用程序、它们的构建状态,以及关联的组件和服务。

4.1. 先决条件

要在 Topology 视图中查看应用程序并与之交互,请确保:

- 已登陆到 web 控制台。

- 在项目中拥有适当的角色和权限,可在 OpenShift Container Platform 中创建应用程序和其他工作负载。

- 您已使用 Developer 视角在 OpenShift Container Platform 上创建并部署了应用程序。。

- 处于 Developer 视角。

4.2. 查看应用程序拓扑

您可以使用 Developer 视角中的左侧导航面板进入 Topology 视图。部署应用程序后,您会自动定向到 Graph view,从中可查看应用程序 pod 状态,快速访问公共 URL 上的应用程序,访问源代码以进行修改,以及查看上一次构建的状态。您可以缩放视图来查看特定应用程序的更多详情。

Topology 视图也为您提供了使用 List 视图监控应用程序的选项。使用 List 视图 图标

![]() 查看所有应用程序的列表,并使用 图形视图 图标(

查看所有应用程序的列表,并使用 图形视图 图标(

![]() )切回到图形视图。

)切回到图形视图。

您可以使用以下命令自定义视图:

- 使用 Find by name 字段查找所需组件。搜索结果可能会出现在可见区域之外 ; 点击左侧工具栏中的 Fit to Screen 来改变 Topology 视图的大小来显示所有组件。

使用 Display Options 下拉列表配置各种应用程序的 Topology 视图。这些选项取决于项目中部署的组件的类型:

模式(Connectivity 或 Consumption)

- Connectivity(连接):显示拓扑中不同节点之间的所有连接。

- Consumption(消耗):显示拓扑中所有节点的资源消耗。

展开组

- Virtual Machines:显示或隐藏虚拟机。

- Application Groupings:通过概述应用程序组和与其关联的警报,将应用程序组压缩到卡中。

- Helm Releases:将部署为 Helm Release 的组件整合到卡中,并概述给定的发行版本。

- Knative Services:明确将 Knative Service 组件压缩到包含指定组件概述的卡中。

- Operator Groupings:清除用于将 Operator 部署的组件整合到卡中,并包含给定组的概述。

Show 项基于 Pod Count 或 Labels

- Pod Count:显示组件图标中组件的 pod 数量。

- Labels:显示或隐藏组件标签。

4.3. 与应用程序和组件交互

Web 控制台的 Developer 视角中的 Topology 视图提供了如下可与应用程序和组件进行交互的选项:

-

点 Open URL(

)查看通过公共 URL 上的路由公开的应用程序。

)查看通过公共 URL 上的路由公开的应用程序。

点击 Edit Source code 可访问您的源代码并进行修改。

注意只有使用 From Git、From Catalog 和 From Dockerfile 选项创建了应用程序时,此功能才可用。

-

光标悬停在 Pod 左下方图标上,可查看最新构建的名称及其状态。应用程序构建的状态显示为 New (

)、Pending (

)、Pending (

)、Running (

)、Running (

)、Complemented (

)、Complemented (

)、Failed (

)、Failed (

)和 Canceled(

)和 Canceled(  )。

)。

pod 的状态或阶段由不同的颜色和工具提示来表示:

-

Running (

):pod 绑定到节点,并创建所有容器。至少一个容器仍在运行,或正在启动或重启过程中。

):pod 绑定到节点,并创建所有容器。至少一个容器仍在运行,或正在启动或重启过程中。

-

Not Ready (

):运行多个容器的 pod,不是所有容器都已就绪。

):运行多个容器的 pod,不是所有容器都已就绪。

-

Warning(

):pod 中的容器被终止,但终止没有成功。有些容器可能是其他状态。

):pod 中的容器被终止,但终止没有成功。有些容器可能是其他状态。

-

失败(

):pod 中的所有容器都终止,但至少一个容器出现故障而终止。也代表,容器以非零状态退出,或者被系统终止。

):pod 中的所有容器都终止,但至少一个容器出现故障而终止。也代表,容器以非零状态退出,或者被系统终止。

-

Pending(

):Kubernetes 集群接受 pod,但一个或多个容器尚未设置并准备好运行。这包括 pod 等待调度的时间,以及通过网络下载容器镜像的时间。

):Kubernetes 集群接受 pod,但一个或多个容器尚未设置并准备好运行。这包括 pod 等待调度的时间,以及通过网络下载容器镜像的时间。

-

Succeeded(

):pod 中的所有容器都成功终止,且不会被重启。

):pod 中的所有容器都成功终止,且不会被重启。

-

Terminating(

):当 pod 被删除时,一些 kubectl 命令会显示 Terminating。Terminating 状态不是 pod 的一个阶段。一个 pod 会被赋予一个安全终止期,默认为 30 秒。

):当 pod 被删除时,一些 kubectl 命令会显示 Terminating。Terminating 状态不是 pod 的一个阶段。一个 pod 会被赋予一个安全终止期,默认为 30 秒。

-

Unknown(

):无法获取 pod 状态。此阶段通常是由于与 pod 应该运行的节点通信时出错造成的。

):无法获取 pod 状态。此阶段通常是由于与 pod 应该运行的节点通信时出错造成的。

-

Running (

创建应用程序并部署镜像后,其状态会显示为 Pending。构建应用程序后,它会显示为 Running。

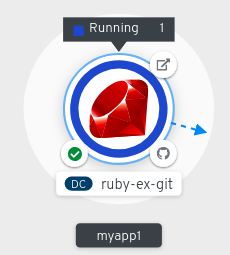

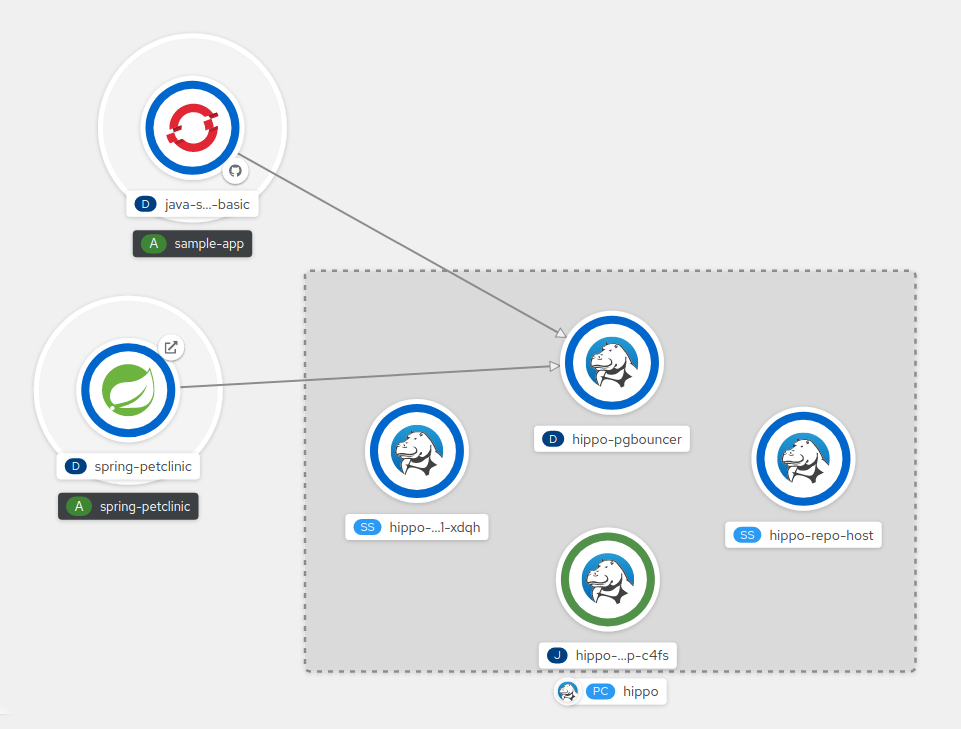

图 4.1. 应用程序拓扑

应用程序资源名称附有代表不同类型资源对象的指示符,如下所示:

-

CJ:

CronJob -

D:

Deployment -

DC:

DeploymentConfig -

DS:

DaemonSet -

J:

Job -

P:

Pod -

SS:

StatefulSet  (Knative):无服务器应用程序

注意

(Knative):无服务器应用程序

注意无服务器应用程序需要一些时间才能加载并显示在 Graph 视图中。部署无服务器应用程序时,首先会创建一个服务资源,然后创建一个修订。之后,它会被部署并显示在 Graph 视图中。如果它是唯一的工作负载,可能会重定向到 Add 页面。部署修订后,无服务器应用程序会显示在 Graph 视图中。

-

CJ:

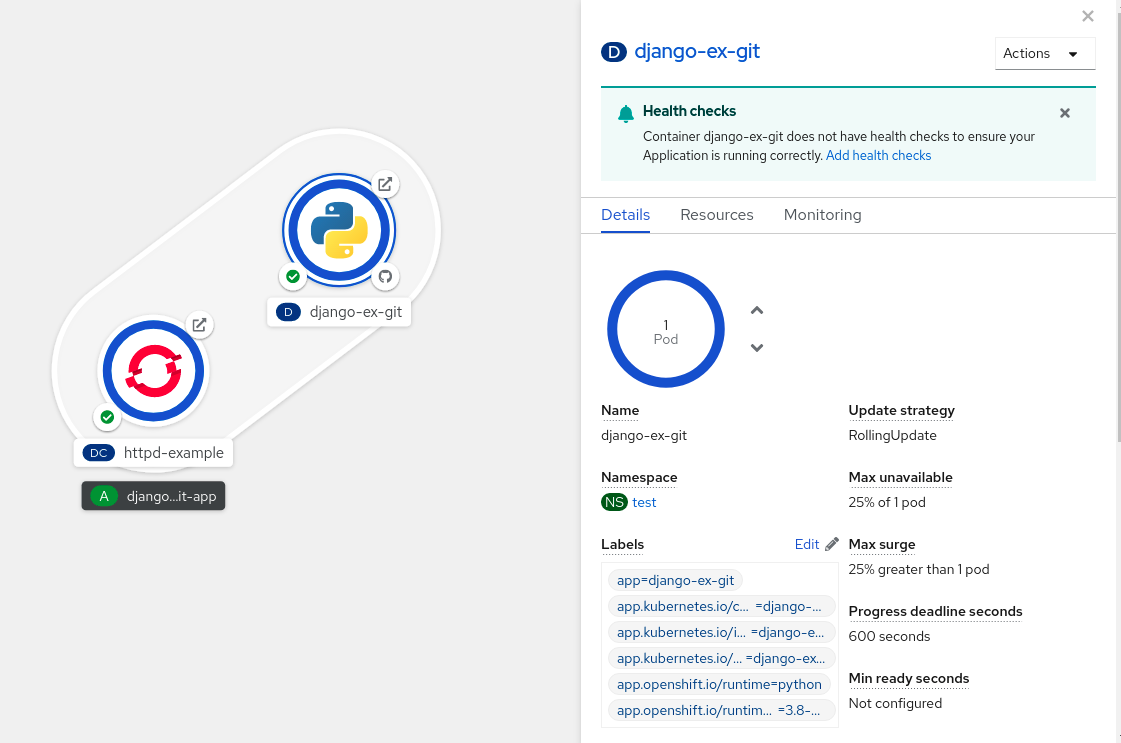

4.4. 扩展应用程序 Pod 以及检查构建和路由

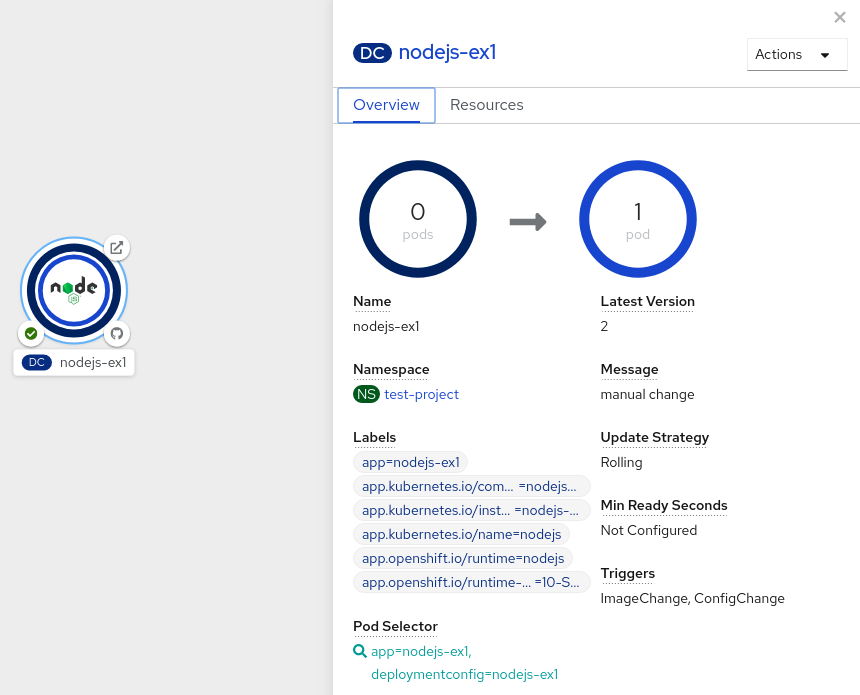

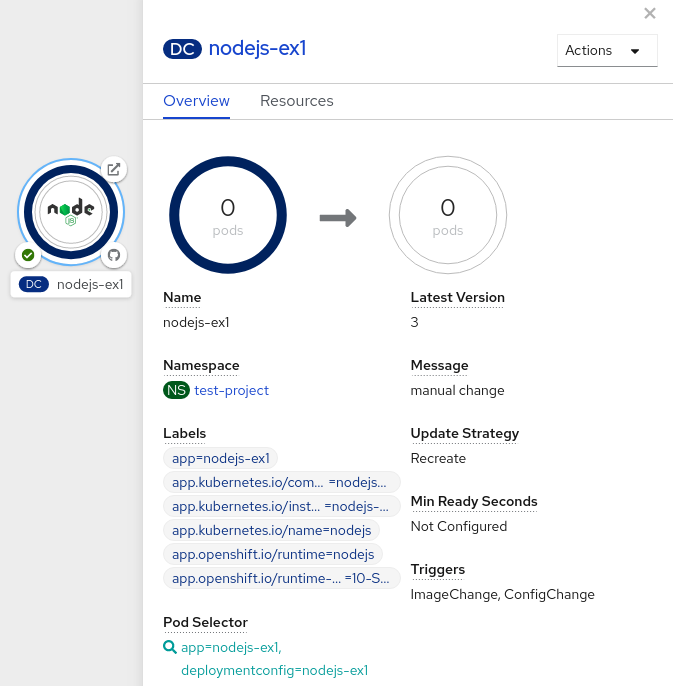

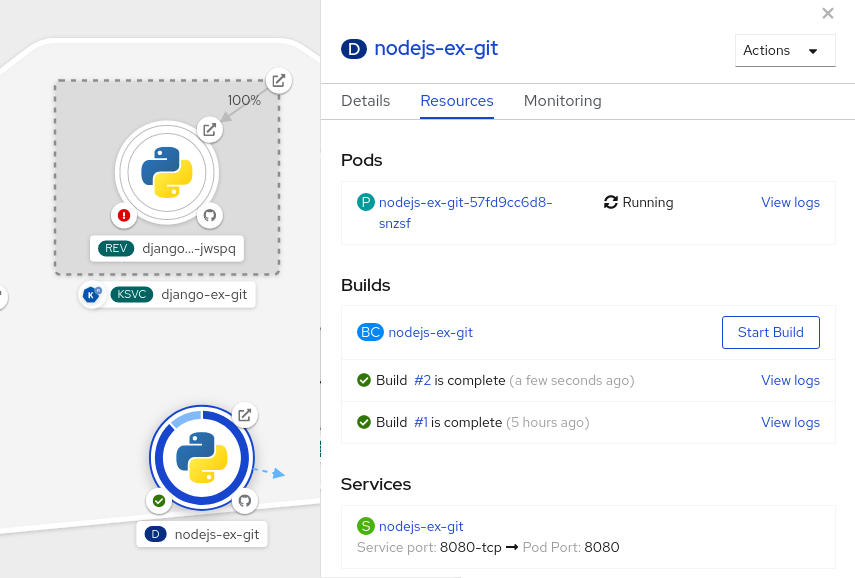

Topology 视图在 Overview 面板中提供所部署组件的详情。您可以使用 Overview 和 Resources 选项卡来缩放应用程序 pod,以及检查构建状态、服务和路由等,如下所示:

点击组件节点,以查看右侧的 Overview 面板。使用 Overview 选项卡可以:

- 使用向上和向下箭头缩放 pod,手动增加或减少应用程序的实例数。对于无服务器应用程序,pod 数在空闲时会自动缩减为零,而且能根据频道流量扩展。

- 检查应用程序的 Labels、Annotations 和 Status。

点击 Resources 选项卡可以:

- 查看所有 pod 列表,查看其状态,访问日志,还能点击 pod 来查看 pod 详情。

- 查看构建及其状态,访问日志,并在需要时启动新的构建。

- 查看组件所使用的服务和路由。

对于无服务器应用程序,Resources 选项卡提供用于该组件的版本、路由和配置的有关信息。

4.5. 将组件添加到现有项目

流程

-

点击左侧导航窗格旁的 Add to Project (

)或按 Ctrl+Space

)或按 Ctrl+Space

- 搜索组件并选择 Create 或按 Enter 将组件添加到项目中,并在拓扑 Graph 视图中查看它。

图 4.2. 通过快速搜索添加组件

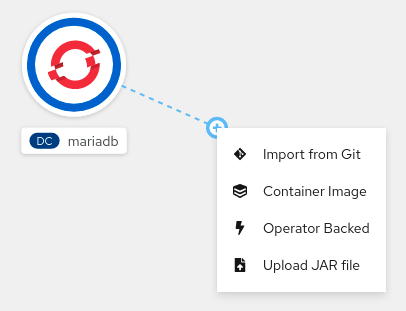

另外,您还可以通过右键单击拓扑 Graph 视图中的上下文菜单中使用 Import from Git、Container Image、Database、From Catalog、Operator Backed、Helm Charts、Samples 或 Upload JAR file 选项来为您的项目添加组件。

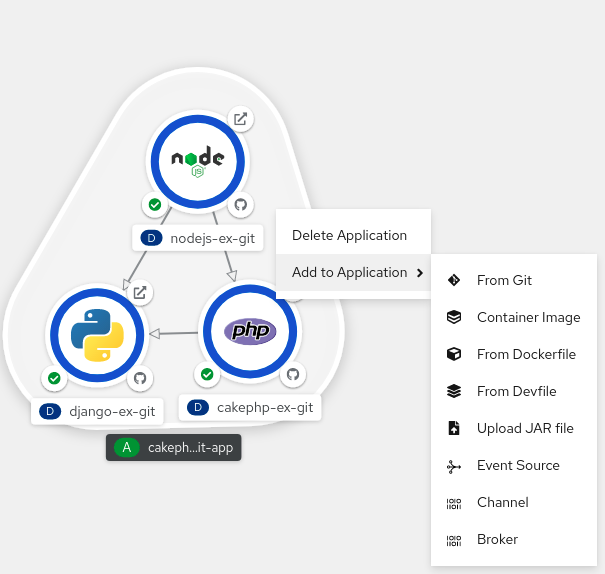

图 4.3. 用于添加服务的上下文菜单

4.6. 对应用程序中的多个组件进行分组

您可以使用 +Add 视图在项目中添加多个组件或服务,并使用拓扑 图形视图 对应用程序组中的应用程序和资源进行分组。

先决条件

- 您已使用 Developer 视角 在 OpenShift Container Platform 上创建并部署了最少两个或多个组件。

流程

要将服务添加到现有应用程序组中,请按 Shift+ 将它拖动到现有应用程序组中。拖动组件并将其添加到应用程序组中时,会将所需的标签添加到组件。

图 4.4. 应用程序分组

另外,您还可以在应用程序中添加组件,如下所示:

- 点服务 pod 查看右侧的 Overview 面板。

- 单击 Actions 下拉菜单,再选择 Edit Application Grouping。

- 在 Edit Application Grouping 对话框中,单击 Application 下拉列表,然后选择适当的应用程序组。

- 单击 Save,将服务添加到应用组中。

要从应用程序组中删除组件,您可以选择组件并使用 Shift+ 拖动操作将组件从应用程序组中拖出。

4.7. 在应用程序中添加服务

要在应用程序中添加服务,请使用使用拓扑 图形视图中 的上下文菜单的 +Add 操作。

除了上下文菜单外,您还可以使用边栏添加服务,或者将鼠标悬停在应用程序组中并拖动悬挂的箭头。

流程

右键单击拓扑 图形视图中的应用程序组,以显示上下文菜单。

图 4.5. 添加资源上下文菜单

- 使用 Add to Application 选择将服务添加到应用程序组中的方法,如 From Git、Container Image、From Dockerfile、From Devfile、Upload JAR 文件、Event Source、Channel 或 Broker。

- 完成您选择的方法的表单,再单击 Create。例如,若要根据 Git 存储库中的源代码添加服务,请选择 From Git 方法,填写 Import from Git 表单,然后单击 Create。

4.8. 从应用程序中删除服务

在拓扑 图形视图中,使用上下文菜单从应用程序中删除服务。

流程

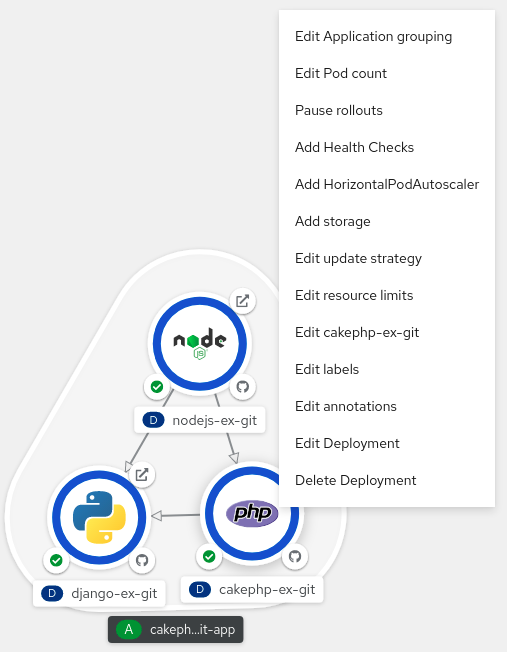

- 在拓扑 图形视图中的应用程序组中右键单击应用程序组中的服务,以显示上下文菜单。

选择 Delete Deployment 以删除服务。

图 4.6. 删除部署选项

4.9. 用于 Topology 视图的标签和注解

Topology 使用下列标签和注解:

- 节点中显示的图标

-

节点中的图标是通过使用

app.openshift.io/runtime标签(随后是app.kubernetes.io/name标签)查找匹配图标来定义的。这种匹配是通过预定义的图标集合来完成的。 - 到源代码编辑器或源的链接

-

app.openshift.io/vcs-uri注解用于创建源代码编辑器的链接。 - 节点连接器

-

app.openshift.io/connects-to注解用于连接节点。 - 应用程序分组

-

app.kubernetes.io/part-of=<appname>标签用于对应用程序、服务和组件进行分组。

如需了解 OpenShift Container Platform 应用程序必须使用的标签和注解,请参阅 OpenShift 应用程序的标签和注解指南。

第 5 章 将应用程序连接到服务

5.1. Service Binding Operator 发行注记

Service Binding Operator 由一个控制器和附带的自定义资源定义 (CRD) 组成,用于服务绑定。它管理工作负载的数据平面并提供支持服务。Service Binding Controller 读取由后备服务的 control plane 提供的数据。然后,它会根据通过 ServiceBinding 资源指定的规则将这些数据到工作负载。

使用 Service Binding Operator,您可以:

- 将工作负载与 Operator 管理的后备服务绑定。

- 自动配置绑定数据。

- 为服务提供商提供低接触管理经验,以调配和管理对服务的访问。

- 通过一致、声明性的服务绑定方法增强开发生命周期,消除群集环境中的差异。

5.1.1. 使开源包含更多

红帽致力于替换我们的代码、文档和 Web 属性中存在问题的语言。我们从这四个术语开始:master、slave、黑名单和白名单。这些更改将在即将发行的几个发行本中逐渐实施。详情请查看 Red Hat CTO Chris Wright 信息。

5.1.2. Service Binding Operator 1.0.1 发行注记

Service Binding Operator 现在包括在 OpenShift Container Platform 4.7、4.8 和 4.9 中。

Service Binding Operator 1.0.1 支持 OpenShift Container Platform 4.9 及之后的版本运行:

- IBM Power 系统

- IBM Z 和 LinuxONE

Service Binding Operator 1.0.1 的自定义资源定义(CRD)支持以下 API:

-

使用

binding.operators.coreos.comAPI 组的服务绑定。 服务绑定(Spec API 技术预览),使用

servicebinding.ioAPI 组。重要带有

servicebinding.ioAPI 组的 Service Binding (Spec API Tech Preview) 只是一个技术预览功能。技术预览功能不受红帽产品服务等级协议(SLA)支持,且功能可能并不完整。红帽不推荐在生产环境中使用它们。这些技术预览功能可以使用户提早试用新的功能,并有机会在开发阶段提供反馈意见。有关红帽技术预览功能支持范围的更多信息,请参阅技术预览功能支持范围。

5.1.2.1. 支持列表

这个版本中的一些功能当前还处于技术预览状态。它们并不适用于在生产环境中使用。

在下表中,功能被标记为以下状态:

- TP: 技术预览

- GA: 正式发行

请参阅红帽门户网站中关于对技术预览功能支持范围的信息:

| 功能 | Service Binding Operator 1.0.1 |

|---|---|

|

| GA |

|

| TP |

5.1.2.2. 修复的问题

-

在此次更新之前,从 CR 的

postgresql.k8s.enterpriesedb.io/v1API 的Cluster自定义资源(CR)中绑定数据值,从 CR 的.metadata.name字段收集主机绑定值。收集的绑定值是不正确的主机名,正确的主机名在.status.writeService字段中可用。在这个版本中,Service Binding Operator 用来公开后备服务 CR 的绑定数据值的注解现在被修改为从.status.writeService字段收集主机绑定值。Service Binding Operator 使用这些修改的注解来将正确的主机名注入到主机和供应商绑定中。APPSVC-1040 -

在这个更新之前,当您绑定

postgres-operator.crunchydata.com/v1beta1API 的PostgresClusterCR 时,绑定数据值不包括数据库证书的值。因此,应用程序无法连接到数据库。在这个版本中,对 Service Binding Operator 用来从后备服务 CR 中公开绑定数据的注解的修改现在包含数据库证书。Service Binding Operator 使用以下修改后的注解来生成正确的ca.crt、tls.crt和tls.key证书文件。APPSVC-1045 -

在此次更新之前,当绑定

pxc.percona.comAPI 的PerconaXtraDBCluster自定义资源(CR)时,绑定数据值不包括端口和数据库值。这些绑定值与其他已注入的绑定值是应用程序成功连接到数据库服务所需的值。在这个版本中,Service Binding Operator 用来公开服务 CR 的绑定数据值的注解现在被修改为项目额外的端口和数据库绑定值。Service Binding Operator 使用以下修改后的注解来生成完整的、应用程序用于成功连接到数据库服务所需的绑定值。APPSVC-1073

5.1.2.3. 已知问题

目前,当您在单一命名空间安装模式下安装 Service Binding Operator 时,因为缺少一些命名空间范围的访问控制(RBAC)规则,所以应用程序可能无法成功绑定到 Service Binding Operator 可自动探测和绑定到的、几个已知的 Operator 支持的服务。另外,还会生成以下出错信息:

错误信息示例

`postgresclusters.postgres-operator.crunchydata.com "hippo" is forbidden: User "system:serviceaccount:my-petclinic:service-binding-operator" cannot get resource "postgresclusters" in API group "postgres-operator.crunchydata.com" in the namespace "my-petclinic"`临时解决方案 1:在

all namespaces安装模式中安装 Service Binding Operator。这样,会存在适当的集群范围的 RBAC 规则,绑定会成功。临时解决方案 2:如果无法在

all namespaces安装模式下安装 Service Binding Operator,在安装了 Service Binding Operator 的命名空间中安装以下角色绑定:示例:用于 Crunchy Postgres Operator 的角色绑定

kind: RoleBinding apiVersion: rbac.authorization.k8s.io/v1 metadata: name: service-binding-crunchy-postgres-viewer subjects: - kind: ServiceAccount name: service-binding-operator roleRef: apiGroup: rbac.authorization.k8s.io kind: ClusterRole name: service-binding-crunchy-postgres-viewer-role

5.1.3. Service Binding Operator 1.0 发行注记

Service Binding Operator 现在包括在 OpenShift Container Platform 4.7、4.8 和 4.9 中。

Service Binding Operator 1.0 的自定义资源定义 (CRD) 支持以下 API:

-

使用

binding.operators.coreos.comAPI 组的服务绑定。 服务绑定(Spec API 技术预览),使用

servicebinding.ioAPI 组。重要带有

servicebinding.ioAPI 组的 Service Binding (Spec API Tech Preview) 只是一个技术预览功能。技术预览功能不受红帽产品服务等级协议(SLA)支持,且功能可能并不完整。红帽不推荐在生产环境中使用它们。这些技术预览功能可以使用户提早试用新的功能,并有机会在开发阶段提供反馈意见。有关红帽技术预览功能支持范围的更多信息,请参阅技术预览功能支持范围。

5.1.3.1. 支持列表

这个版本中的一些功能当前还处于技术预览状态。它们并不适用于在生产环境中使用。

在下表中,功能被标记为以下状态:

- TP: 技术预览

- GA: 正式发行

请参阅红帽门户网站中关于对技术预览功能支持范围的信息:

| 功能 | Service Binding Operator 1.0 |

|---|---|

|

| GA |

|

| TP |

5.1.3.2. 新功能

Service Binding Operator 1.0 支持 OpenShift Container Platform 4.9 及之后的版本运行:

- IBM Power 系统

- IBM Z 和 LinuxONE

本节重点介绍了 Service Binding Operator 1.0 中的新功能:

公开服务的绑定数据

- 根据 CRD、自定义资源 (CR) 或资源中的注解。

- 基于 Operator Lifecycle Manager (OLM) 描述符中存在的描述符。

- 支持置备的服务

工作负载投射

- 使用卷挂载以文件形式预测绑定数据。

- 绑定数据作为环境变量的投射。

服务绑定选项

- 在与工作负载命名空间不同的命名空间中绑定后备服务。

- 项目绑定数据到特定的容器工作负载。

- 自动检测来自后备服务 CR 拥有的资源的绑定数据。

- 编写来自公开绑定数据的自定义绑定数据。

-

支持非

PodSpec兼容工作负载资源。

安全性

- 支持基于角色的访问控制 (RBAC)。

5.1.4. 其他资源

5.2. 了解 Service Binding Operator

应用程序开发人员需要访问支持的服务,以构建和连接工作负载。连接工作负载以支持服务始终是一个挑战,因为每个服务提供商建议以不同方式访问其机密并在工作负载中使用它们。此外,手动配置和维护这种工作负载和后备服务组合,使得流程变得繁琐、效率低下且容易出错。

Service Binding Operator 可让应用程序开发人员将工作负载与 Operator 管理的后备服务轻松绑定,而无需任何手动步骤来配置绑定连接。

5.2.1. 服务绑定术语

本节总结了服务绑定中使用的基本术语。

| 服务绑定 | 提供向工作负载提供服务的信息的操作表示。例如,在 Java 应用程序和它所需的数据库之间建立凭据交换。 |

| 后端服务 | 应用在网络上运行的任何服务或软件作为其正常操作的一部分。示例包括数据库、消息代理、带 REST 端点的应用、事件流、应用程序性能监控器 (APM) 或硬件安全模块 (HSM)。 |

| 工作负载(应用程序) | 任何在容器内运行的进程。示例包括 Spring Boot 应用、NodeJS Express 应用或 Ruby on Rails 应用。 |

| 绑定数据 | 有关用于配置集群中其他资源行为的服务的信息。示例包括凭证、连接详情、卷挂载或 secret。 |

| 绑定连接 | 任何在连接的组件(如可绑定后备服务)和需要支持服务的应用程序之间建立交互的连接。 |

5.2.2. 关于 Service Binding Operator

Service Binding Operator 由一个控制器和附带的自定义资源定义 (CRD) 组成,用于服务绑定。它管理工作负载的数据平面并提供支持服务。Service Binding Controller 读取由后备服务的 control plane 提供的数据。然后,它会根据通过 ServiceBinding 资源指定的规则将这些数据到工作负载。

因此,Service Binding Operator 通过自动收集和与工作负载共享绑定数据,使工作负载能够使用后备服务或外部服务。这个过程包括使后备服务绑定,并将工作负载和服务绑定在一起。

5.2.2.1. 使 Operator 管理的后备服务可绑定

要使服务可绑定,作为 Operator 供应商,您需要公开工作负载所需的绑定数据,以便与 Operator 提供的服务绑定。您可以在管理后备服务的 Operator CRD 中以注解或描述符形式提供绑定数据。

5.2.2.2. 将工作负载与后备服务绑定

通过将 Service Binding Operator 用作应用程序开发人员,您需要声明建立绑定连接的意图。您必须创建一个 Service Binding CR 来引用后备服务。此操作会触发 Service Binding Operator 将公开的绑定数据项目到工作负载中。Service Binding Operator 接收声明的意图,并将工作负载与后备服务绑定。

Service Binding Operator 的 CRD 支持以下 API:

-

使用

binding.operators.coreos.comAPI 组的服务绑定。 服务绑定(Spec API 技术预览),使用

servicebinding.ioAPI 组。重要带有

servicebinding.ioAPI 组的 Service Binding (Spec API Tech Preview) 只是一个技术预览功能。技术预览功能不受红帽产品服务等级协议(SLA)支持,且功能可能并不完整。红帽不推荐在生产环境中使用它们。这些技术预览功能可以使用户提早试用新的功能,并有机会在开发阶段提供反馈意见。有关红帽技术预览功能支持范围的详情,请参考 https://access.redhat.com/support/offerings/techpreview/。

使用 Service Binding Operator,您可以:

- 将工作负载绑定到 Operator 管理的后备服务。

- 自动配置绑定数据。

- 为服务提供商提供低接触管理经验,以调配和管理对服务的访问。

- 通过一致、声明性的服务绑定方法增强开发生命周期,消除群集环境中的差异。

5.2.3. 主要特性

公开服务的绑定数据

- 根据 CRD、自定义资源 (CR) 或资源中的注解。

- 基于 Operator Lifecycle Manager (OLM) 描述符中存在的描述符。

工作负载投射

- 使用卷挂载以文件形式预测绑定数据。

- 绑定数据作为环境变量的投射。

服务绑定选项

- 在与工作负载命名空间不同的命名空间中绑定后备服务。

- 项目绑定数据到特定的容器工作负载。

- 自动检测来自后备服务 CR 拥有的资源的绑定数据。

- 编写来自公开绑定数据的自定义绑定数据。

-

支持非

PodSpec兼容工作负载资源。

安全性

- 支持基于角色的访问控制 (RBAC)。

5.2.4. 其他资源

5.3. 安装 Service Binding Operator

本指南指导集群管理员完成将 Service Binding Operator 安装到 OpenShift Container Platform 集群的过程。

您可以在 OpenShift Container Platform 4.7 及更新的版本上安装 Service Binding Operator。

5.3.1. 使用 Web 控制台安装 Service Binding Operator

您可以使用 OpenShift Container Platform OperatorHub 安装 Service Binding Operator。安装 Service Binding Operator 时,服务绑定配置所需的自定义资源 (CR) 将与 Operator 一起自动安装。

先决条件

可以使用具有 cluster-admin 权限的账户访问 OpenShift Container Platform 集群。

流程

- 在控制台的 Administrator 视角中,导航到 Operators → OperatorHub。

-

使用 Filter by keyword 复选框在目录中搜索

Service Binding Operator。点 Service Binding Operator 标题。 - 阅读 Service Binding Operator 页面中有关 Operator 的简单描述。点 Install。

在 Install Operator 页面中:

-

为 Installation Mode 选择 All namespaces on the cluster (default)。选择该项会将 Operator 安装至默认

openshift-operators命名空间,这将启用 Operator 以进行监视并在集群中的所有命名空间中可用。 - 为 Approval Strategy 选择 Automatic。这样可确保以后对 Operator 的升级由 Operator Lifecycle Manager (OLM) 自动进行。如果您选择 Manual 批准策略,OLM 会创建一个更新请求。作为集群管理员,您必须手动批准 OLM 更新请求,才可将 Operator 更新至新版本。

选择一个 Update Channel。

- 默认情况下,stable 频道启用 Service Binding Operator 最新稳定且受支持的发行版本。

-

为 Installation Mode 选择 All namespaces on the cluster (default)。选择该项会将 Operator 安装至默认

点 Install。

注意Operator 会自动安装到

openshift-operators命名空间中。- 在 Installed Operator — ready for use 窗格中,点 View Operator。您会看到 Installed Operators 页面中列出的 Operator。

- 验证 Status 是否已设置为 Succeeded 来确认已成功安装 Service Binding Operator。

5.3.2. 其它资源

5.4. 服务绑定入门

Service Binding Operator 管理工作负载和后备服务的数据平面。本指南提供了一些示例,可帮助您创建数据库实例、部署应用程序,以及使用 Service Binding Operator 在应用程序和数据库服务间创建绑定连接。

先决条件

-

可以使用具有

cluster-admin权限的账户访问 OpenShift Container Platform 集群。 -

已安装

ocCLI。 - 已从 OperatorHub 安装了 Service Binding Operator。

已使用 v5 Update 频道从 OperatorHub 安装了 Crunchy Postgres for Kubernetes Operator。安装的 Operator 在适当的命名空间中可用,如

my-petclinic命名空间。注意您可以使用

oc create namespace my-petclinic命令创建命名空间。

5.4.1. 创建 PostgreSQL 数据库实例

要创建 PostgreSQL 数据库实例,您必须创建一个 PostgresCluster 自定义资源 (CR) 并配置数据库。

流程

在 shell 中运行以下命令来在

my-petclinic命名空间中创建PostgresClusterCR:$ oc apply -n my-petclinic -f - << EOD --- apiVersion: postgres-operator.crunchydata.com/v1beta1 kind: PostgresCluster metadata: name: hippo spec: image: registry.developers.crunchydata.com/crunchydata/crunchy-postgres-ha:centos8-13.4-0 postgresVersion: 13 instances: - name: instance1 dataVolumeClaimSpec: accessModes: - "ReadWriteOnce" resources: requests: storage: 1Gi backups: pgbackrest: image: registry.developers.crunchydata.com/crunchydata/crunchy-pgbackrest:centos8-2.33-2 repos: - name: repo1 volume: volumeClaimSpec: accessModes: - "ReadWriteOnce" resources: requests: storage: 1Gi - name: repo2 volume: volumeClaimSpec: accessModes: - "ReadWriteOnce" resources: requests: storage: 1Gi proxy: pgBouncer: image: registry.developers.crunchydata.com/crunchydata/crunchy-pgbouncer:centos8-1.15-2 EOD此

PostgresClusterCR 中的注解启用服务绑定连接并触发 Operator 协调。输出会验证数据库实例是否已创建:

输出示例

postgrescluster.postgres-operator.crunchydata.com/hippo created创建数据库实例后,确保

my-petclinic命名空间中的所有 pod 都在运行:$ oc get pods -n my-petclinic输出(需要几分钟)验证是否创建并配置了数据库:

输出示例

NAME READY STATUS RESTARTS AGE hippo-backup-nqjg-2rq94 1/1 Running 0 35s hippo-instance1-nw92-0 3/3 Running 0 112s hippo-pgbouncer-57b98f4476-znsk5 2/2 Running 0 112s hippo-repo-host-0 1/1 Running 0 112s配置了数据库后,您可以部署示例应用程序并将其连接到数据库服务。

5.4.2. 部署 Spring PetClinic 示例应用程序

要在 OpenShift Container Platform 集群上部署 Spring PetClinic 示例应用程序,您必须使用部署配置并配置本地环境才能测试应用程序。

流程

在 shell 中运行以下命令,使用

PostgresCluster自定义资源(CR)部署spring-petclinic应用程序:$ oc apply -n my-petclinic -f - << EOD --- apiVersion: apps/v1 kind: Deployment metadata: name: spring-petclinic labels: app: spring-petclinic spec: replicas: 1 selector: matchLabels: app: spring-petclinic template: metadata: labels: app: spring-petclinic spec: containers: - name: app image: quay.io/service-binding/spring-petclinic:latest imagePullPolicy: Always env: - name: SPRING_PROFILES_ACTIVE value: postgres ports: - name: http containerPort: 8080 --- apiVersion: v1 kind: Service metadata: labels: app: spring-petclinic name: spring-petclinic spec: type: NodePort ports: - port: 80 protocol: TCP targetPort: 8080 selector: app: spring-petclinic EOD输出会验证 Spring PetClinic 示例应用是否已创建并部署:

输出示例

deployment.apps/spring-petclinic created service/spring-petclinic created注意如果要在 web 控制台的 Developer 视角中使用 容器镜像 部署应用程序,则必须在高级选项的 Deployment 部分输入以下环境变量:

- 名称:SPRING_PROFILES_ACTIVE

- 值: postgres

运行以下命令,验证应用程序是否还没有连接到数据库服务:

$ oc get pods -n my-petclinic显示

CrashLoopBackOff状态需要几分钟时间 :输出示例

NAME READY STATUS RESTARTS AGE spring-petclinic-5b4c7999d4-wzdtz 0/1 CrashLoopBackOff 4 (13s ago) 2m25s在这个阶段,pod 无法启动。如果您尝试与应用交互,它会返回错误。

现在,您可以使用 Service Binding Operator 将应用程序连接到数据库服务。

5.4.3. 将 Spring PetClinic 示例应用程序连接到 PostgreSQL 数据库服务

要将示例应用程序连接到数据库服务,您必须创建一个 ServiceBinding 自定义资源 (CR),该资源会触发 Service Binding Operator 将绑定数据项目到应用程序中。

流程

创建

ServiceBindingCR 以项目绑定数据:$ oc apply -n my-petclinic -f - << EOD --- apiVersion: binding.operators.coreos.com/v1alpha1 kind: ServiceBinding metadata: name: spring-petclinic-pgcluster spec: services:1 - group: postgres-operator.crunchydata.com version: v1beta1 kind: PostgresCluster2 name: hippo application:3 name: spring-petclinic group: apps version: v1 resource: deployments EOD输出会验证是否已创建

ServiceBindingCR 以将绑定数据项目到示例应用程序中。输出示例

servicebinding.binding.operators.coreos.com/spring-petclinic created验证服务绑定的请求是否成功:

$ oc get servicebindings -n my-petclinic输出示例

NAME READY REASON AGE spring-petclinic-pgcluster True ApplicationsBound 7s默认情况下,来自数据库服务的绑定数据的值作为运行示例应用程序的工作负载容器中的文件进行投射。例如,Secret 资源中的所有值都投射到

bindings/spring-petclinic-pgcluster目录中。注意另外,您还可以通过打印出目录内容来验证应用程序中的文件是否包含投射绑定数据:

$ for i in username password host port type; do oc exec -it deploy/spring-petclinic -n my-petclinic -- /bin/bash -c 'cd /tmp; find /bindings/*/'$i' -exec echo -n {}:" " \; -exec cat {} \;'; echo; done输出示例:使用来自 secret 资源的所有值

/bindings/spring-petclinic-pgcluster/username: hippo /bindings/spring-petclinic-pgcluster/password: KXKF{nAI,I-J6zLt:W+FKnze /bindings/spring-petclinic-pgcluster/host: hippo-primary.my-petclinic.svc /bindings/spring-petclinic-pgcluster/port: 5432 /bindings/spring-petclinic-pgcluster/type: postgresql设置应用程序端口的端口转发,以便从本地环境访问示例应用程序:

$ oc port-forward --address 0.0.0.0 svc/spring-petclinic 8080:80 -n my-petclinic输出示例

Forwarding from 0.0.0.0:8080 -> 8080 Handling connection for 8080访问 http://localhost:8080/petclinic。

现在,您可以在 localhost:8080 远程访问 Spring PetClinic 示例应用程序,并查看应用程序现在连接到数据库服务。

5.4.4. 其它资源

5.5. 在 IBM Power Systems、IBM Z 和 LinuxONE 上使用服务绑定

Service Binding Operator 管理工作负载和后备服务的数据平面。本指南提供了一些示例,可帮助您创建数据库实例、部署应用程序,以及使用 Service Binding Operator 在应用程序和数据库服务间创建绑定连接。

先决条件

-

可以使用具有

cluster-admin权限的账户访问 OpenShift Container Platform 集群。 -

已安装

ocCLI。 - 您已从 OperatorHub 安装 Service Binding Operator。

5.5.1. 部署 PostgreSQL Operator

流程

-

要在

my-petclinic命名空间中部署 Dev4Devs PostgreSQL Operator,请在 shell 中运行以下命令:

$ oc apply -f - << EOD

---

apiVersion: v1

kind: Namespace

metadata:

name: my-petclinic

---

apiVersion: operators.coreos.com/v1

kind: OperatorGroup

metadata:

name: postgres-operator-group

namespace: my-petclinic

---

apiVersion: operators.coreos.com/v1alpha1

kind: CatalogSource

metadata:

name: ibm-multiarch-catalog

namespace: openshift-marketplace

spec:

sourceType: grpc

image: quay.io/ibm/operator-registry-<architecture>

imagePullPolicy: IfNotPresent

displayName: ibm-multiarch-catalog

updateStrategy:

registryPoll:

interval: 30m

---

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: postgresql-operator-dev4devs-com

namespace: openshift-operators

spec:

channel: alpha

installPlanApproval: Automatic

name: postgresql-operator-dev4devs-com

source: ibm-multiarch-catalog

sourceNamespace: openshift-marketplace

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:

name: database-view

labels:

servicebinding.io/controller: "true"

rules:

- apiGroups:

- postgresql.dev4devs.com

resources:

- databases

verbs:

- get

- list

EOD- 1

- Operator 镜像。

-

对于 IBM Power:

quay.io/ibm/operator-registry-ppc64le:release-4.9 -

对于 IBM Z 和 LinuxONE:

quay.io/ibm/operator-registry-s390x:release-4.8

-

对于 IBM Power:

验证

安装 Operator 后,列出

openshift-operators命名空间中的 Operator 订阅:$ oc get subs -n openshift-operators输出示例

NAME PACKAGE SOURCE CHANNEL postgresql-operator-dev4devs-com postgresql-operator-dev4devs-com ibm-multiarch-catalog alpha rh-service-binding-operator rh-service-binding-operator redhat-operators stable

5.5.2. 创建 PostgreSQL 数据库实例

要创建 PostgreSQL 数据库实例,您必须创建一个 Database 自定义资源(CR)并配置数据库。

流程

在 shell 中运行以下命令来在

my-petclinic命名空间中创建DatabaseCR:$ oc apply -f - << EOD apiVersion: postgresql.dev4devs.com/v1alpha1 kind: Database metadata: name: sampledatabase namespace: my-petclinic annotations: host: sampledatabase type: postgresql port: "5432" service.binding/database: 'path={.spec.databaseName}' service.binding/port: 'path={.metadata.annotations.port}' service.binding/password: 'path={.spec.databasePassword}' service.binding/username: 'path={.spec.databaseUser}' service.binding/type: 'path={.metadata.annotations.type}' service.binding/host: 'path={.metadata.annotations.host}' spec: databaseCpu: 30m databaseCpuLimit: 60m databaseMemoryLimit: 512Mi databaseMemoryRequest: 128Mi databaseName: "sampledb" databaseNameKeyEnvVar: POSTGRESQL_DATABASE databasePassword: "samplepwd" databasePasswordKeyEnvVar: POSTGRESQL_PASSWORD databaseStorageRequest: 1Gi databaseUser: "sampleuser" databaseUserKeyEnvVar: POSTGRESQL_USER image: registry.redhat.io/rhel8/postgresql-13:latest databaseStorageClassName: nfs-storage-provisioner size: 1 EOD此

DatabaseCR 中添加的注解可启用服务绑定连接并触发 Operator 协调。输出会验证数据库实例是否已创建:

输出示例

database.postgresql.dev4devs.com/sampledatabase created创建数据库实例后,确保

my-petclinic命名空间中的所有 pod 都在运行:$ oc get pods -n my-petclinic输出(需要几分钟)验证是否创建并配置了数据库:

输出示例

NAME READY STATUS RESTARTS AGE sampledatabase-cbc655488-74kss 0/1 Running 0 32s

配置了数据库后,您可以部署示例应用程序并将其连接到数据库服务。

5.5.3. 部署 Spring PetClinic 示例应用程序

要在 OpenShift Container Platform 集群上部署 Spring PetClinic 示例应用程序,您必须使用部署配置并配置本地环境才能测试应用程序。

流程

在 shell 中运行以下命令,使用

PostgresCluster自定义资源(CR)部署spring-petclinic应用程序:$ oc apply -n my-petclinic -f - << EOD --- apiVersion: apps/v1 kind: Deployment metadata: name: spring-petclinic labels: app: spring-petclinic spec: replicas: 1 selector: matchLabels: app: spring-petclinic template: metadata: labels: app: spring-petclinic spec: containers: - name: app image: quay.io/service-binding/spring-petclinic:latest imagePullPolicy: Always env: - name: SPRING_PROFILES_ACTIVE value: postgres - name: org.springframework.cloud.bindings.boot.enable value: "true" ports: - name: http containerPort: 8080 --- apiVersion: v1 kind: Service metadata: labels: app: spring-petclinic name: spring-petclinic spec: type: NodePort ports: - port: 80 protocol: TCP targetPort: 8080 selector: app: spring-petclinic EOD输出会验证 Spring PetClinic 示例应用是否已创建并部署:

输出示例

deployment.apps/spring-petclinic created service/spring-petclinic created注意如果要在 web 控制台的 Developer 视角中使用 容器镜像 部署应用程序,则必须在高级选项的 Deployment 部分输入以下环境变量:

- 名称:SPRING_PROFILES_ACTIVE

- 值: postgres

运行以下命令,验证应用程序是否还没有连接到数据库服务:

$ oc get pods -n my-petclinic显示

CrashLoopBackOff状态需要几分钟:输出示例

NAME READY STATUS RESTARTS AGE spring-petclinic-5b4c7999d4-wzdtz 0/1 CrashLoopBackOff 4 (13s ago) 2m25s在这个阶段,pod 无法启动。如果您尝试与应用交互,它会返回错误。

现在,您可以使用 Service Binding Operator 将应用程序连接到数据库服务。

5.5.4. 将 Spring PetClinic 示例应用程序连接到 PostgreSQL 数据库服务

要将示例应用程序连接到数据库服务,您必须创建一个 ServiceBinding 自定义资源 (CR),该资源会触发 Service Binding Operator 将绑定数据项目到应用程序中。

流程

创建

ServiceBindingCR 以项目绑定数据:$ oc apply -n my-petclinic -f - << EOD --- apiVersion: binding.operators.coreos.com/v1alpha1 kind: ServiceBinding metadata: name: spring-petclinic-pgcluster spec: services:1 - group: postgresql.dev4devs.com kind: Database2 name: sampledatabase version: v1alpha1 application:3 name: spring-petclinic group: apps version: v1 resource: deployments EOD输出会验证是否已创建

ServiceBindingCR 以将绑定数据项目到示例应用程序中。输出示例

servicebinding.binding.operators.coreos.com/spring-petclinic created验证服务绑定的请求是否成功:

$ oc get servicebindings -n my-petclinic输出示例

NAME READY REASON AGE spring-petclinic-postgresql True ApplicationsBound 47m默认情况下,来自数据库服务的绑定数据的值作为运行示例应用程序的工作负载容器中的文件进行投射。例如,Secret 资源中的所有值都投射到

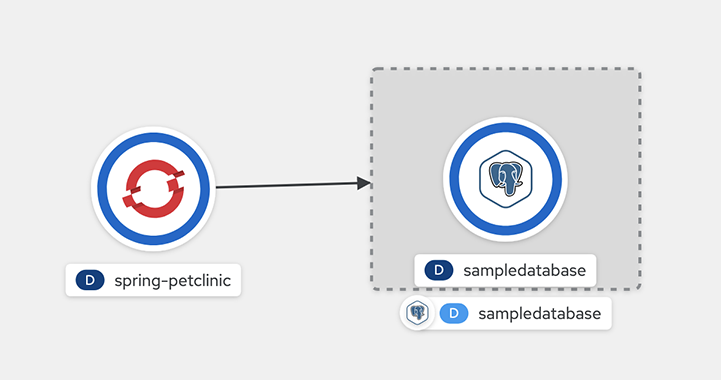

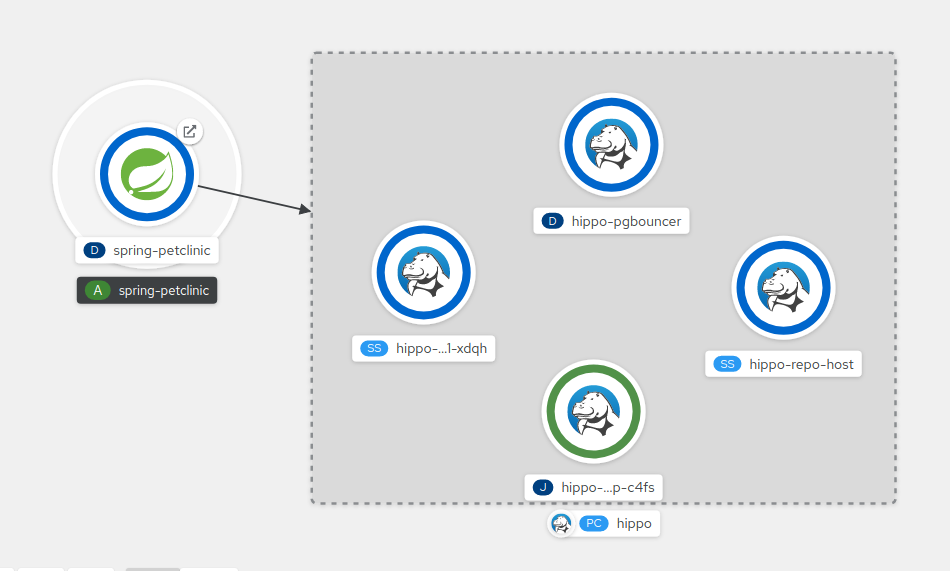

bindings/spring-petclinic-pgcluster目录中。创建后,您可以进入拓扑来查看可视连接。

图 5.1. 将 spring-petclinic 连接到示例数据库

设置应用程序端口的端口转发,以便从本地环境访问示例应用程序:

$ oc port-forward --address 0.0.0.0 svc/spring-petclinic 8080:80 -n my-petclinic输出示例

Forwarding from 0.0.0.0:8080 -> 8080 Handling connection for 8080现在,您可以在 localhost:8080 远程访问 Spring PetClinic 示例应用程序,并查看应用程序现在连接到数据库服务。

5.6. 从服务公开绑定数据

应用程序开发人员需要访问支持的服务,以构建和连接工作负载。连接工作负载以支持服务始终是一个挑战,因为每个服务提供商需要以不同的方式访问其机密并在工作负载中使用它们。

Service Binding Operator 可让应用程序开发人员将工作负载与 Operator 管理的后备服务轻松绑定,而无需任何手动步骤来配置绑定连接。要使 Service Binding Operator 作为 Operator 供应商或创建后备服务的用户提供绑定数据,您必须公开绑定数据,以便 Service Binding Operator 自动检测到绑定数据。然后,Service Binding Operator 会自动从后备服务收集绑定数据,并将其与工作负载共享,以提供一致且可预测的体验。

5.6.1. 公开绑定数据的方法

本节论述了您可以使用什么方法公开绑定数据。

确保您了解并了解您的工作负载要求和环境,以及如何与所提供的服务配合使用。

在以下情况下公开绑定数据:

后备服务作为调配的服务资源提供。

您要连接到的服务符合 Service Binding 规格。您必须创建一个带有所有所需绑定数据值的

Secret资源,并在后备服务自定义资源 (CR) 中引用它。所有绑定数据值的检测都是自动的。后备服务不能作为调配的服务资源使用。

您必须从后备服务公开绑定数据。根据工作负载要求和环境,您可以选择以下任一方法公开绑定数据:

- 直接 secret 引用

- 通过自定义资源定义(CRD)或 CR 注解声明绑定数据

- 通过拥有的资源检测绑定数据

5.6.1.1. 置备的服务

置备的服务代表后端服务 CR,引用了放置在后备服务 CR 的 .status.binding.name 字段中的 Secret 资源。

作为 Operator 供应商或创建后备服务的用户,您可以通过创建 Secret 资源并在后备服务 CR 的 .status.binding.name 部分中引用它,使用此方法符合 Service Binding 规格。此 Secret 资源必须提供工作负载连接到后备服务所需的所有绑定数据值。

以下示例显示一个 AccountService CR,它代表一个后备服务和从 CR 引用的 Secret 资源。

示例: AccountService CR

apiVersion: example.com/v1alpha1

kind: AccountService

name: prod-account-service

spec:

...

status:

binding:

name: hippo-pguser-hippo示例:引用的 Secret 资源

apiVersion: v1

kind: Secret

metadata:

name: hippo-pguser-hippo

data:

password: "MTBz"

user: "Z3Vlc3Q="

...

在创建服务绑定资源时,您可以在 ServiceBinding 规格中直接提供 AccountService 资源的详情,如下所示:

示例: ServiceBinding 资源

apiVersion: binding.operators.coreos.com/v1alpha1

kind: ServiceBinding

metadata:

name: account-service

spec:

...

services:

- group: "example.com"

version: v1alpha1

kind: AccountService

name: prod-account-service

application:

name: spring-petclinic

group: apps

version: v1

resource: deployments

带有 servicebinding.io API 组的 Service Binding (Spec API Tech Preview) 只是一个技术预览功能。技术预览功能不受红帽产品服务等级协议(SLA)支持,且功能可能并不完整。红帽不推荐在生产环境中使用它们。这些技术预览功能可以使用户提早试用新的功能,并有机会在开发阶段提供反馈意见。有关红帽技术预览功能支持范围的详情,请参考 https://access.redhat.com/support/offerings/techpreview/。

示例: Specification API 中的 ServiceBinding 资源

apiVersion: servicebinding.io/v1alpha3

kind: ServiceBinding

metadata:

name: account-service

spec:

...

service:

apiVersion: example.com/v1alpha1

kind: AccountService

name: prod-account-service

application:

apiVersion: apps/v1

kind: Deployment

name: spring-petclinic

此方法公开 hippo-pguser-hippo 所引用 Secret 资源中的所有键作为绑定数据,以投射到工作负载中。

5.6.1.2. 直接 secret 引用

如果所有必需的绑定数据值都位于 Service Binding 定义中可以引用的 Secret 资源中,您可以使用此方法。在这个方法中,ServiceBinding 资源直接引用 Secret 资源来连接服务。Secret 资源中的所有键都公开为绑定数据。

示例:带有 binding.operators.coreos.com API 的规格

apiVersion: binding.operators.coreos.com/v1alpha1

kind: ServiceBinding

metadata:

name: account-service

spec:

...

services:

- group: ""

version: v1

kind: Secret

name: hippo-pguser-hippo示例:符合 servicebinding.io API 的规格

apiVersion: servicebinding.io/v1alpha3

kind: ServiceBinding

metadata:

name: account-service

spec:

...

service:

apiVersion: v1

kind: Secret

name: hippo-pguser-hippo5.6.1.3. 通过 CRD 或 CR 注解声明绑定数据

您可以使用此方法注解后备服务的资源,以使用特定注解公开绑定数据。在 metadata 部分下添加注解会改变后备服务的 CR 和 CRD。Service Binding Operator 会检测添加到 CR 和 CRD 的注解,然后使用基于注解提取的值创建一个 Secret 资源。

以下示例显示了在 metadata 部分添加的注解以及从资源引用的 ConfigMap 对象:

示例:从 CR 注解中定义的 Secret 对象公开绑定数据

apiVersion: postgres-operator.crunchydata.com/v1beta1

kind: PostgresCluster

metadata:

name: hippo

namespace: my-petclinic

annotations:

service.binding: 'path={.metadata.name}-pguser-{.metadata.name},objectType=Secret'

...

前面的示例将 secret 名称放在 {.metadata.name}-pguser-{.metadata.name} 模板中,该模板解析为 hippo-pguser-hippo。模板可以包含多个 JSONPath 表达式。

示例:从一个资源中参考的 Secret 对象

apiVersion: v1

kind: Secret

metadata:

name: hippo-pguser-hippo

data:

password: "MTBz"

user: "Z3Vlc3Q="示例:从 CR 注解中定义的 ConfigMap 对象公开绑定数据

apiVersion: postgres-operator.crunchydata.com/v1beta1

kind: PostgresCluster

metadata:

name: hippo

namespace: my-petclinic

annotations:

service.binding: 'path={.metadata.name}-config,objectType=ConfigMap'

...

前面的示例将配置映射的名称放在解析到 hippo-config 的 {.metadata.name}-config 模板中。模板可以包含多个 JSONPath 表达式。

示例:从资源引用的 ConfigMap 对象

apiVersion: v1

kind: ConfigMap

metadata:

name: hippo-config

data:

db_timeout: "10s"

user: "hippo"5.6.1.4. 通过拥有的资源检测绑定数据

如果您的后备服务拥有一个或多个 Kubernetes 资源,如路由、服务、配置映射或 secret,您可以使用此方法检测绑定数据。在这个方法中,Service Binding Operator 会检测来自后备服务 CR 拥有的资源的绑定数据。

以下示例显示 ServiceBinding CR 中的 detectBindingResources API 选项设置为 true :

示例

apiVersion: binding.operators.coreos.com/v1alpha1

kind: ServiceBinding

metadata:

name: spring-petclinic-detect-all

namespace: my-petclinic

spec:

detectBindingResources: true

services:

- group: postgres-operator.crunchydata.com

version: v1beta1

kind: PostgresCluster

name: hippo

application:

name: spring-petclinic

group: apps

version: v1

resource: deployments

在上例中,PostgresCluster 自定义资源拥有一个或多个 Kubernetes 资源,如路由、服务、配置映射或 secret。

Service Binding Operator 会自动检测每个拥有的资源上公开的绑定数据。

5.6.2. 数据模型

注释中使用的数据模型遵循特定的惯例。

服务绑定注解必须使用以下约定:

service.binding(/<NAME>)?:

"<VALUE>|(path=<JSONPATH_TEMPLATE>(,objectType=<OBJECT_TYPE>)?(,elementType=<ELEMENT_TYPE>)?(,sourceKey=<SOURCE_KEY>)?(,sourceValue=<SOURCE_VALUE>)?)"其中:

|

|

指定要公开的绑定值的名称。只有在将 |

|

|

指定没有设置 |

数据模型详细介绍了 路径、elementType、objectType、sourceKey 和 sourceValue 参数允许的值和语义。

| 参数 | 描述 | 默认值 |

|---|---|---|

|

| 包含以大括号 {} 括起的 JSONPath 表达式的 jsonpath 模板。 | 不适用 |

|

|

指定

|

|

|

|

指定 |

|

|

|

指定在收集绑定数据时要添加到绑定 secret 的 备注:

| 不适用 |

|

|

指定映射片段中的键。 备注:

| 不适用 |

只有在 path 参数中指示的元素引用 ConfigMap 或 Secret 资源时,sourceKey 和 sourceValue 参数才适用。

5.6.3. RBAC 要求

要使用 Service Binding Operator 来公开后备服务绑定数据,您需要特定的基于角色的访问控制(RBAC)权限。在 ClusterRole 资源的 rules 字段下指定特定的操作动词,以便为后备服务资源授予 RBAC 权限。在定义这些规则时,允许 Service Binding Operator 在整个集群中读取后备服务资源的绑定数据。如果用户没有读取绑定数据或修改应用程序资源的权限,Service Binding Operator 会阻止这样的用户将服务绑定到应用程序。遵循 RBAC 要求避免用户不必要的权限,并防止访问未经授权的服务或应用程序。

Service Binding Operator 使用专用服务帐户对 Kubernetes API 执行请求。默认情况下,此帐户具有将服务绑定到工作负载的权限,它们都由以下标准 Kubernetes 或 OpenShift 对象表示:

-

部署 -

DaemonSets -

ReplicaSet -

StatefulSets -

DeploymentConfig

Operator 服务帐户绑定到一个聚合的集群角色,允许 Operator 供应商或集群管理员启用将自定义服务资源绑定到工作负载。要在 ClusterRole 中授予所需的权限,请为它标上 servicebinding.io/controller 标志,并将标志值设为 true。以下示例演示了如何允许 Service Binding Operator get、watch、list Crunchy PostgreSQL Operator 的自定义资源(CR):

示例:启用到 Crunchy PostgreSQL Operator 置备的 PostgreSQL 数据库实例的绑定

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:

name: postgrescluster-reader

labels:

servicebinding.io/controller: "true"

rules:

- apiGroups:

- postgres-operator.crunchydata.com

resources:

- postgresclusters

verbs:

- get

- watch

- list

...此集群角色可以在安装支持服务 Operator 的过程中部署。

5.6.4. 可公开绑定数据的类别

Service Binding Operator 可让您从后备服务资源和自定义资源定义 (CRD) 中公开绑定数据值。

本节提供了示例,以演示如何使用各种可混合绑定数据类别。您必须修改这些示例,以符合您的工作环境和要求。

5.6.4.1. 从资源公开字符串

以下示例演示了如何将 PostgresCluster 自定义资源 (CR) 的 metadata.name 字段中的字符串公开为用户名:

示例

apiVersion: postgres-operator.crunchydata.com/v1beta1

kind: PostgresCluster

metadata:

name: hippo

namespace: my-petclinic

annotations:

service.binding/username: path={.metadata.name}

...5.6.4.2. 将常量值作为绑定项目公开

以下示例演示了如何从 PostgresCluster 自定义资源(CR)公开一个常量值:

示例:公开一个常量值

apiVersion: postgres-operator.crunchydata.com/v1beta1

kind: PostgresCluster

metadata:

name: hippo

namespace: my-petclinic

annotations:

"service.binding/type": "postgresql" - 1

- 绑定

type使用postgresql值被公开。

5.6.4.3. 公开从资源引用的整个配置映射或 secret

以下示例演示了如何通过注解公开整个 secret:

示例:通过注解公开整个 secret

apiVersion: postgres-operator.crunchydata.com/v1beta1

kind: PostgresCluster

metadata:

name: hippo

namespace: my-petclinic

annotations:

service.binding: 'path={.metadata.name}-pguser-{.metadata.name},objectType=Secret'示例:从后备服务资源引用的 secret

apiVersion: v1

kind: Secret

metadata:

name: hippo-pguser-hippo

data:

password: "MTBz"

user: "Z3Vlc3Q="5.6.4.4. 从一个配置映射或 secret(从一个资源指代) 中公开一个特定条目

以下示例演示了如何通过注解从配置映射中公开特定条目:

示例:通过注解从配置映射中公开条目

apiVersion: postgres-operator.crunchydata.com/v1beta1

kind: PostgresCluster

metadata:

name: hippo

namespace: my-petclinic

annotations:

service.binding: 'path={.metadata.name}-config,objectType=ConfigMap,sourceKey=user'示例:从后备服务资源引用的配置映射

绑定数据应具有名称为 db_timeout 的键,值为 10s :

apiVersion: v1

kind: ConfigMap

metadata:

name: hippo-config

data:

db_timeout: "10s"

user: "hippo"5.6.4.5. 公开资源定义值

以下示例演示了如何通过注解公开资源定义值:

示例:通过注解公开资源定义值

apiVersion: postgres-operator.crunchydata.com/v1beta1

kind: PostgresCluster

metadata:

name: hippo

namespace: my-petclinic

annotations:

service.binding/username: path={.metadata.name}

...5.6.4.6. 使用每个条目的键和值公开集合条目

以下示例演示了如何通过注解使用每个条目的键和值公开集合条目:

示例:通过注解公开集合条目

apiVersion: postgres-operator.crunchydata.com/v1beta1

kind: PostgresCluster

metadata:

name: hippo

namespace: my-petclinic

annotations:

"service.binding/uri": "path={.status.connections},elementType=sliceOfMaps,sourceKey=type,sourceValue=url"

spec:

...

status:

connections:

- type: primary

url: primary.example.com

- type: secondary

url: secondary.example.com

- type: '404'

url: black-hole.example.com以下示例演示了注解中集合的先前条目如何投射到绑定应用程序中。

示例:绑定数据文件

/bindings/<binding-name>/uri_primary => primary.example.com

/bindings/<binding-name>/uri_secondary => secondary.example.com

/bindings/<binding-name>/uri_404 => black-hole.example.com示例:从后备服务资源配置

status:

connections:

- type: primary

url: primary.example.com

- type: secondary

url: secondary.example.com

- type: '404'

url: black-hole.example.com

以上示例可帮助您使用键(如 primary, secondary)将这些值组织为项目。

5.6.4.7. 使用每个项目一个键公开集合的项目

以下示例演示了如何通过注解在各个项目中使用一个键来公开集合项目:

示例:通过注解公开集合项目

apiVersion: postgres-operator.crunchydata.com/v1beta1

kind: PostgresCluster

metadata:

name: hippo

namespace: my-petclinic

annotations:

"service.binding/tags": "path={.spec.tags},elementType=sliceOfStrings"

spec:

tags:

- knowledge

- is

- power以下示例演示了注解中集合的先前项目如何投射到绑定应用程序中。

示例:绑定数据文件

/bindings/<binding-name>/tags_0 => knowledge

/bindings/<binding-name>/tags_1 => is

/bindings/<binding-name>/tags_2 => power示例:从后备服务资源配置

spec:

tags:

- knowledge

- is

- power5.6.4.8. 每个条目使用一个键公开集合条目的值

以下示例演示了如何通过注解使用每个条目值的一个键公开集合条目的值:

示例:通过注解公开集合条目的值

apiVersion: postgres-operator.crunchydata.com/v1beta1

kind: PostgresCluster

metadata:

name: hippo

namespace: my-petclinic

annotations:

"service.binding/url": "path={.spec.connections},elementType=sliceOfStrings,sourceValue=url"

spec:

connections:

- type: primary

url: primary.example.com

- type: secondary

url: secondary.example.com

- type: '404'

url: black-hole.example.com以下示例演示了注解中集合的先前值如何投射到绑定应用程序中。

示例:绑定数据文件

/bindings/<binding-name>/url_0 => primary.example.com

/bindings/<binding-name>/url_1 => secondary.example.com

/bindings/<binding-name>/url_2 => black-hole.example.com5.6.5. 其他资源

5.7. 投射绑定数据

本节提供有关如何使用绑定数据的信息。

5.7.1. 绑定数据的消耗

在后备服务公开绑定数据后,如果工作负载要访问和使用这个数据,您必须将其从后备服务中项目到工作负载中。Service Binding Operator 会自动以以下方法将这一数据集项目到工作负载中:

- 默认情况下,作为文件。

-

作为环境变量,在从

ServiceBinding资源配置.spec.bindAsFiles参数后。

5.7.2. 配置目录路径来项目工作负载容器内绑定数据

默认情况下,Service Binding Operator 将绑定数据作为文件挂载到工作负载资源的特定目录中。您可以使用运行工作负载的容器中的 SERVICE_BINDING_ROOT 环境变量设置来配置目录路径。

示例:绑定数据作为文件挂载

$SERVICE_BINDING_ROOT

├── account-database

│ ├── type

│ ├── provider

│ ├── uri

│ ├── username

│ └── password

└── transaction-event-stream

├── type

├── connection-count

├── uri

├── certificates

└── private-key要将绑定数据用作环境变量,请使用您选择的编程语言的内置语言功能,可以读取环境变量。

示例:Python 客户端使用

import os

username = os.getenv("USERNAME")

password = os.getenv("PASSWORD")5.7.2.1. 计算将绑定数据作为文件投射的最终路径

下表总结了在将文件挂载到特定目录中时如何计算绑定数据投射的最终路径的配置:

SERVICE_BINDING_ROOT | 最终路径 |

|---|---|

| 不可用 |

|

|

|

|

在上表中,<ServiceBinding_ResourceName> 条目指定您在自定义资源 (CR) 的 .metadata.name 部分中配置的 ServiceBinding 资源的名称。

要在现有 SERVICE_BINDING_ROOT 环境变量中访问和使用绑定数据,请使用您选择的编程语言的内置语言功能来读取环境变量。

示例:Python 客户端使用

from pyservicebinding import binding

try:

sb = binding.ServiceBinding()

except binding.ServiceBindingRootMissingError as msg:

# log the error message and retry/exit

print("SERVICE_BINDING_ROOT env var not set")

sb = binding.ServiceBinding()

bindings_list = sb.bindings("postgresql")

在上例中,bindings_list 变量包含 postgresql 数据库服务类型的绑定数据。

5.7.3. 投射绑定数据

根据工作负载要求和环境,您可以选择将绑定数据作为文件或环境变量进行项目。

先决条件

您了解以下概念:

- 环境和工作负载要求,以及其如何与所提供的服务配合使用。

- 在工作负载资源中消耗绑定数据。

- 配置如何为默认方法计算数据投射的最终路径。

- 绑定数据从后备服务公开。

流程

-

若要将绑定数据显示为文件,请确保工作负载运行的容器中存在现有的

SERVICE_BINDING_ROOT环境变量,以确定目标文件夹。 -

要将绑定数据作为环境变量进行项目,请将自定义资源 (CR) 中

ServiceBinding资源中的.spec.bindAsFiles参数的值设置为false。

5.7.4. 其他资源

5.8. 使用 Service Binding Operator 绑定工作负载

应用程序开发人员必须使用绑定 secret 将工作负载绑定到一个或多个后端服务。生成此 secret 是为了存储工作负载要使用的信息。

例如,假设您要连接的服务已公开绑定数据。在这种情况下,您还需要将工作负载与 ServiceBinding 自定义资源(CR)一同使用。通过使用此 ServiceBinding CR,工作负载发送带有要绑定的服务详情的绑定请求。

ServiceBinding CR 示例

apiVersion: binding.operators.coreos.com/v1alpha1

kind: ServiceBinding

metadata:

name: spring-petclinic-pgcluster

namespace: my-petclinic

spec:

services:

- group: postgres-operator.crunchydata.com

version: v1beta1

kind: PostgresCluster

name: hippo

application:

name: spring-petclinic

group: apps

version: v1

resource: deployments

如上例所示,您还可以直接使用 ConfigMap 或 Secret 本身用作绑定数据源的服务资源。

5.8.1. 命名策略

命名策略仅适用于 binding.operators.coreos.com API 组。

命名策略使用 Go 模板来帮助通过服务绑定请求定义自定义绑定名称。命名策略适用于所有属性,包括 ServiceBinding 自定义资源(CR)中的映射。

后端服务项目将名称作为文件或环境变量绑定到工作负载。如果工作负载需要特定格式的项目绑定名称,但从后端服务投射绑定名称不能以该格式提供,那么您可以使用命名策略更改绑定名称。

预定义的后处理功能

在使用命名策略时,根据您的工作负载的期望或要求,您可以在任意组合中使用以下预定义的后处理功能来转换字符字符串:

-

大写:将字符串中的字符转换为大写。 -

小写:将字符串中的字符转换为小写。 -

标题:转字符串中的每个单词的第一个字母大写(某些次要单词除外)。

预定义的命名策略

根据以下预定义的命名策略,处理通过注解声明的绑定名称来更改工作负载:

none:应用时,绑定名称没有任何更改。示例

在模板编译后,绑定名称采用

{{ .name }}形式。host: hippo-pgbouncer port: 5432upper: 在没有定义namingStrategy时应用。应用时,将绑定名称的字符串转换为大写。示例

模板编译后,绑定名称采用

{{ .service.kind | upper}}_{{ .name | upper }}格式。DATABASE_HOST: hippo-pgbouncer DATABASE_PORT: 5432如果您的工作负载需要不同的格式,您可以定义自定义命名策略并使用前缀和分隔符更改绑定名称,如

PORT_DATABASE。

-

当绑定名称作为文件进行投射时,默认情况下会应用预定义的

none命名策略,绑定名称不会改变。 -

当绑定名称作为环境变量进行投射且没有定义

namingStrategy时,会默认应用预定义的uppercase命名策略。 - 您可以使用自定义绑定名称和预定义的后处理函数定义自定义命名策略来覆盖预定义的命名策略。

5.8.2. 高级绑定选项

高级绑定选项仅适用于 binding.operators.coreos.com API 组。

5.8.2.1. 在将绑定名称改到工作负载前更改绑定名称

您可以指定规则来更改 ServiceBinding 自定义资源(CR)的 .spec.namingStrategy 属性中的绑定名称。例如,假设一个连接到 PostgreSQL 数据库的 Spring PetClinic 示例应用程序。在本例中,PostgreSQL 数据库服务公开数据库的主机和端口字段,以用于绑定。Spring PetClinic 示例应用程序可以通过绑定名称访问此公开绑定数据。

示例: ServiceBinding CR 中的 Spring PetClinic 示例应用程序

...

application:

name: spring-petclinic

group: apps

version: v1

resource: deployments

...示例: ServiceBinding CR 中的 PostgreSQL 数据库服务

...

services:

- group: postgres-operator.crunchydata.com

version: v1beta1

kind: PostgresCluster

name: hippo

...

如果未定义 namingStrategy 且绑定名称作为环境变量,则后备服务中的 host: hippo-pgbouncer 值,并且投射环境变量将如以下示例所示:

示例

DATABASE_HOST: hippo-pgbouncer其中:

|

|

指定 |

|

| 指定绑定名称。 |

应用 POSTGRESQL_{{ .service.kind | upper }}_{{ .name | upper }}_ENV 命名策略后,服务绑定请求准备的自定义绑定名称列表如下所示:

示例

POSTGRESQL_DATABASE_HOST_ENV: hippo-pgbouncer

POSTGRESQL_DATABASE_PORT_ENV: 5432

以下项目描述了 POSTGRESQL_{{ .service.kind | upper }}_{{ .name | upper }}_ENV 命名策略中定义的表达式:

-

.name: 请参阅由支持服务公开的绑定名称。在上例中,绑定名称为HOST和PORT。 -

.service.kind:请参阅其绑定名称通过命名策略更改的服务资源类型。 -

upper:用于在编译 Go 模板字符串时处理字符字符串的字符串的字符串。 -

POSTGRESQL:自定义绑定名称的前缀。 -

ENV:自定义绑定名称的修复。

与前面的示例类似,您可以在 namingStrategy 中定义字符串模板,以定义如何由服务绑定请求准备绑定名称的每个键。

5.8.2.2. 编写自定义绑定数据

作为应用程序开发人员,您可以在以下情况下编写自定义绑定数据:

- 后备服务不公开绑定数据。

- 所公开的值不能以所需格式提供,工作负载符合预期。

例如,如果后备服务 CR 将主机、端口和数据库用户公开为绑定数据,但工作负载要求将绑定数据用作连接字符串。您可以使用代表支持服务的 Kubernetes 资源中的属性编写自定义绑定数据。

示例

apiVersion: binding.operators.coreos.com/v1alpha1

kind: ServiceBinding

metadata:

name: spring-petclinic-pgcluster

namespace: my-petclinic

spec:

services:

- group: postgres-operator.crunchydata.com

version: v1beta1

kind: PostgresCluster

name: hippo

id: postgresDB

- group: ""

version: v1

kind: Secret

name: hippo-pguser-hippo

id: postgresSecret

application:

name: spring-petclinic

group: apps

version: v1

resource: deployments

mappings:

## From the database service

- name: JDBC_URL

value: 'jdbc:postgresql://{{ .postgresDB.metadata.annotations.proxy }}:{{ .postgresDB.spec.port }}/{{ .postgresDB.metadata.name }}'

## From both the services!

- name: CREDENTIALS

value: '{{ .postgresDB.metadata.name }}{{ translationService.postgresSecret.data.password }}'

## Generate JSON

- name: DB_JSON

value: {{ json .postgresDB.status }} 5.8.3. 绑定与 PodSpec 不兼容的二级工作负载

服务绑定中的典型场景涉及配置后端服务、工作负载(Deployment)和 Service Binding Operator。考虑涉及与 PodSpec 不兼容且位于主工作负载(Deployment)和 Service Binding Operator 之间的辅助工作负载(也可以是一个应用程序 Operator)的场景。

对于这样的辅助工作负载资源,容器路径的位置是任意的。对于服务绑定,如果 CR 中的辅助工作负载与 PodSpec 不兼容,您必须指定容器路径的位置。这样做可以将数据绑定到 ServiceBinding 自定义资源(CR)的二级工作负载中指定的容器路径中,例如,当您不想在一个 pod 中绑定数据时。

Service Binding Operator 提供了一个选项,用于配置容器路径或 secret 路径在自定义位置上绑定这些路径的值。当绑定数据作为环境变量被投射时,这个选项只适用于 binding.operators.coreos.com API 组。

5.8.3.1. 配置容器路径的自定义位置

考虑辅助工作负载 CR,它不与 PodSpec 兼容,并且具有位于 spec.containers 路径的容器:

示例:二级工作负载 CR

apiVersion: "operator.sbo.com/v1"

kind: SecondaryWorkload

metadata:

name: secondary-workload

spec:

containers:

- name: hello-world

image: quay.io/baijum/secondary-workload:latest

ports:

- containerPort: 8080流程

通过在

ServiceBindingCR 中指定值并将此路径绑定到spec.application.bindingPath.containersPath自定义位置来配置spec.containers路径:示例:带有自定义位置的

spec.containers路径的ServiceBindingCRapiVersion: binding.operators.coreos.com/v1alpha1 kind: ServiceBinding metadata: name: spring-petclinic-pgcluster spec: services: - group: postgres-operator.crunchydata.com version: v1beta1 kind: PostgresCluster name: hippo id: postgresDB - group: "" version: v1 kind: Secret name: hippo-pguser-hippo id: postgresSecret application:1 name: spring-petclinic group: apps version: v1 resource: deployments application:2 name: secondary-workload group: operator.sbo.com version: v1 resource: secondaryworkloads bindingPath: containersPath: spec.containers3

指定容器路径的位置后,Service Binding Operator 会生成绑定数据,该数据在 ServiceBinding CR 的二级工作负载中指定的容器路径中可用。

以下示例显示了带有 envFrom 和 secretRef 字段的 spec.containers 路径:

示例:带有 envFrom 和 secretRef 字段的二级工作负载 CR

apiVersion: "operator.sbo.com/v1"

kind: SecondaryWorkload

metadata:

name: secondary-workload

spec:

containers:

- env:

- name: ServiceBindingOperatorChangeTriggerEnvVar

value: "31793"

envFrom:

- secretRef:

name: secret-resource-name

image: quay.io/baijum/secondary-workload:latest

name: hello-world

ports:

- containerPort: 8080

resources: {}5.8.3.2. 配置 secret 路径的自定义位置

考虑与 PodSpec 不兼容的辅助工作负载 CR,且只有 spec.secret 路径中的 secret:

示例:二级工作负载 CR

apiVersion: "operator.sbo.com/v1"

kind: SecondaryWorkload

metadata:

name: secondary-workload

spec:

secret: ""流程

通过在

ServiceBindingCR 中指定值并在spec.application.bindingPath.secretPath自定义位置上绑定这个路径来配置spec.secret路径:示例:带有自定义位置

spec.secret路径的ServiceBindingCRapiVersion: binding.operators.coreos.com/v1alpha1 kind: ServiceBinding metadata: name: spring-petclinic-pgcluster spec: ... application:1 name: secondary-workload group: operator.sbo.com version: v1 resource: secondaryworkloads bindingPath: secretPath: spec.secret2 ...

指定 secret 路径的位置后,Service Binding Operator 会生成绑定数据,该数据在 ServiceBinding CR 的二级工作负载中指定的 secret 路径中可用。

以下示例显示了带有 binding-request 值的 spec.secret 路径:

示例:使用 binding-request 值进行二级工作负载 CR

...

apiVersion: "operator.sbo.com/v1"

kind: SecondaryWorkload

metadata:

name: secondary-workload

spec:

secret: binding-request-72ddc0c540ab3a290e138726940591debf14c581

...- 1

- Service Binding Operator 生成的

Secret资源的唯一名称。

5.8.4. 从后备服务中取消绑定工作负载

您可以使用 oc 工具从后端服务中取消绑定工作负载。

要从后备服务中取消绑定工作负载,请删除链接到该服务的

ServiceBinding自定义资源(CR):$ oc delete ServiceBinding <.metadata.name>示例

$ oc delete ServiceBinding spring-petclinic-pgcluster其中:

spring-petclinic-pgcluster指定

ServiceBindingCR 的名称。

5.8.5. 其他资源

5.9. 使用 Developer 视角将应用程序连接到服务

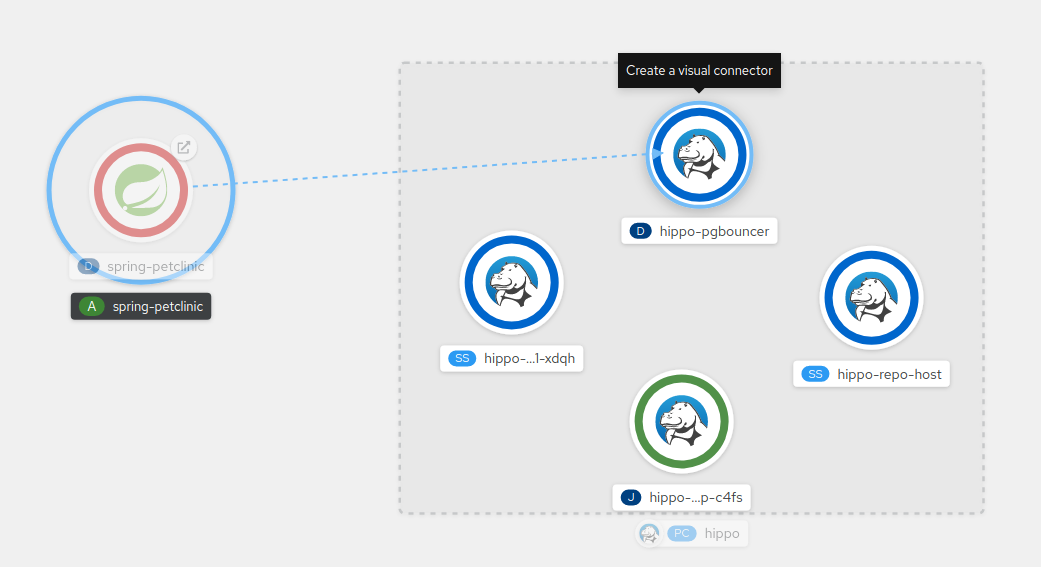

除了对一个应用程序中的多个组件进行分组外,还可以使用 Topology 视图来相互连接组件。您可以使用绑定连接器或视觉连接器来连接组件。

只有当目标节点是 Operator 支持的服务时,才可以在组件之间建立绑定连接。为了表示这种情况,当您将箭头拖到这样的目标节点上时,会出现 Create a binding connector 工具提示。当应用程序使用绑定连接器连接到服务时,会创建一个 ServiceBinding 资源。然后,Service Binding Operator 控制器会将必要的绑定数据项目到应用程序部署中。请求成功后,会重新部署应用程序以在连接的组件间建立交互。

视觉连接器只在组件之间建立视觉连接,描述连接意图。没有建立组件之间的交互。如果目标节点不是一个 Operator 支持的服务,当您将箭头拖到目标节点上时,将会显示 Create a visual connector 工具提示。

5.9.1. 在组件之间创建视觉连接

您可以使用可视连接器来描述连接应用程序组件的意图。

此流程介绍了在 PostgreSQL 数据库服务和 Spring PetClinic 示例应用程序之间创建可视连接的示例。

先决条件