网络

配置 Red Hat OpenShift Service on AWS 网络

摘要

第 1 章 关于网络

Red Hat OpenShift 网络是一个功能、插件和高级网络功能生态系统,它增强了 Kubernetes 网络与高级网络相关的功能,集群需要管理一个或多个混合集群的网络流量。这种网络功能生态系统集成了入口、出口、负载均衡、高性能吞吐量、安全性和集群内部流量管理。Red Hat OpenShift 网络生态系统还提供基于角色的可观察工具来降低其自然复杂性。

以下是集群中一些最常用的 Red Hat OpenShift Networking 功能:

- 用于网络插件管理的 Cluster Network Operator

由以下 Container Network Interface (CNI) 插件之一提供的主要集群网络:

- OVN-Kubernetes 网络插件,这是默认的 CNI 插件。

- OpenShift SDN 网络插件,该插件在 OpenShift 4.16 中已弃用,并在 OpenShift 4.17 中删除。

在将 OpenShift SDN 网络插件配置为版本 4.17 的 ROSA (经典架构)集群前,您必须迁移到 OVN-Kubernetes 网络插件。如需更多信息,请参阅附加资源部分中的 从 OpenShift SDN 网络插件迁移到 OVN-Kubernetes 网络插件。

其他资源

第 2 章 网络 Operator

2.1. AWS Load Balancer Operator

AWS Load Balancer Operator 是红帽支持的 Operator,用户可以选择性地在 SRE 管理的 Red Hat OpenShift Service on AWS (ROSA)集群上安装。AWS Load Balancer Operator 管理 AWS Load Balancer Controller 的生命周期,为 ROSA 集群中运行的应用程序置备 AWS Elastic Load Balancing v2 (ELBv2)服务。

AWS Load Balancer Operator 创建的负载均衡器不能用于 OpenShift 路由,并且只应用于不需要 OpenShift Route 完整第 7 层功能的单个服务或入口资源。

AWS Load Balancer Controller 为 Red Hat OpenShift Service on AWS (ROSA)集群管理 AWS Elastic Load Balancers。当使用类型为 LoadBalancer 的 Kubernetes Service 资源实施 Kubernetes Service 资源时,控制器会在创建 Kubernetes Ingress 资源和 AWS Network Load Balancers (NLB) 时置备 AWS Application Load Balancers (ALB)。

与默认的 AWS 树内负载均衡器供应商相比,这个控制器会使用 ALBs 和 NLBs 的高级注解开发。一些高级用例有:

- 使用带有 ALB 的原生 Kubernetes Ingress 对象

- 将 ALBs 与 AWS Web 应用程序防火墙(WAF)服务集成

- 指定自定义 NLB 源 IP 范围

- 指定自定义 NLB 内部 IP 地址

AWS Load Balancer Operator 用于在 ROSA 集群中安装、管理和配置 aws-load-balancer-controller 实例。

2.1.1. 设置您的环境以安装 AWS Load Balancer Operator

AWS Load Balancer Operator 需要具有多个可用区域(AZ)的集群,以及在同一虚拟私有云(VPC)中跨三个 AZ 分割的公共子网。

由于这些要求,AWS Load Balancer Operator 可能并不适合许多 PrivateLink 集群。AWS NLBs 没有这个限制。

在安装 AWS Load Balancer Operator 前,您必须配置以下内容:

- 具有多个可用区的 ROSA (经典架构)集群

- BYO VPC 集群

- AWS CLI

- OC CLI

2.1.1.1. AWS Load Balancer Operator 环境设置

可选:您可以设置临时环境变量来简化安装命令。

如果您决定不使用环境变量,请手动输入代码片段中提示的值。

流程

以 admin 用户身份登录集群后,运行以下命令:

$ export CLUSTER_NAME=$(oc get infrastructure cluster -o=jsonpath="{.status.infrastructureName}") $ export REGION=$(oc get infrastructure cluster -o=jsonpath="{.status.platformStatus.aws.region}") $ export OIDC_ENDPOINT=$(oc get authentication.config.openshift.io cluster -o jsonpath='{.spec.serviceAccountIssuer}' | sed 's|^https://||') $ export AWS_ACCOUNT_ID=$(aws sts get-caller-identity --query Account --output text) $ export SCRATCH="/tmp/${CLUSTER_NAME}/alb-operator" $ mkdir -p ${SCRATCH}您可以运行以下命令来验证变量是否已设置:

$ echo "Cluster name: ${CLUSTER_NAME}, Region: ${REGION}, OIDC Endpoint: ${OIDC_ENDPOINT}, AWS Account ID: ${AWS_ACCOUNT_ID}"输出示例

Cluster name: <cluster_id>, Region: us-east-2, OIDC Endpoint: oidc.op1.openshiftapps.com/<oidc_id>, AWS Account ID: <aws_id>

2.1.1.2. AWS VPC 和子网

在安装 AWS Load Balancer Operator 之前,您必须标记 AWS VPC 资源。

流程

将环境变量设置为 ROSA 部署的正确值:

$ export VPC_ID=<vpc-id> $ export PUBLIC_SUBNET_IDS="<public-subnet-a-id> <public-subnet-b-id> <public-subnet-c-id>" $ export PRIVATE_SUBNET_IDS="<private-subnet-a-id> <private-subnet-b-id> <private-subnet-c-id>"使用集群名称向集群的 VPC 添加标签:

$ aws ec2 create-tags --resources ${VPC_ID} --tags Key=kubernetes.io/cluster/${CLUSTER_NAME},Value=owned --region ${REGION}在您的公共子网中添加标签:

$ aws ec2 create-tags \ --resources ${PUBLIC_SUBNET_IDS} \ --tags Key=kubernetes.io/role/elb,Value='' \ --region ${REGION}在您的专用子网中添加标签:

$ aws ec2 create-tags \ --resources ${PRIVATE_SUBNET_IDS} \ --tags Key=kubernetes.io/role/internal-elb,Value='' \ --region ${REGION}

- 要设置具有多个可用区的 ROSA 经典集群,请参阅 使用默认选项创建带有 STS 的 ROSA 集群

2.1.2. 安装 AWS Load Balancer Operator

使用集群设置环境后,您可以使用 CLI 安装 AWS Load Balancer Operator。

流程

为 AWS Load Balancer Operator 在集群中创建一个新项目:

$ oc new-project aws-load-balancer-operator为 AWS Load Balancer Controller 创建 AWS IAM 策略:

注意您可以从 上游 AWS Load Balancer Controller 策略找到 AWS IAM 策略。此策略包括 Operator 正常工作所需的所有权限。

$ POLICY_ARN=$(aws iam list-policies --query \ "Policies[?PolicyName=='aws-load-balancer-operator-policy'].{ARN:Arn}" \ --output text) $ if [[ -z "${POLICY_ARN}" ]]; then wget -O "${SCRATCH}/load-balancer-operator-policy.json" \ https://raw.githubusercontent.com/rh-mobb/documentation/main/content/rosa/aws-load-balancer-operator/load-balancer-operator-policy.json POLICY_ARN=$(aws --region "$REGION" --query Policy.Arn \ --output text iam create-policy \ --policy-name aws-load-balancer-operator-policy \ --policy-document "file://${SCRATCH}/load-balancer-operator-policy.json") fi $ echo $POLICY_ARN为 AWS Load Balancer Operator 创建 AWS IAM 信任策略:

$ cat <<EOF > "${SCRATCH}/trust-policy.json" { "Version": "2012-10-17", "Statement": [ { "Effect": "Allow", "Condition": { "StringEquals" : { "${OIDC_ENDPOINT}:sub": ["system:serviceaccount:aws-load-balancer-operator:aws-load-balancer-operator-controller-manager", "system:serviceaccount:aws-load-balancer-operator:aws-load-balancer-controller-cluster"] } }, "Principal": { "Federated": "arn:aws:iam::$AWS_ACCOUNT_ID:oidc-provider/${OIDC_ENDPOINT}" }, "Action": "sts:AssumeRoleWithWebIdentity" } ] } EOF为 AWS Load Balancer Operator 创建 AWS IAM 角色:

$ ROLE_ARN=$(aws iam create-role --role-name "${ROSA_CLUSTER_NAME}-alb-operator" \ --assume-role-policy-document "file://${SCRATCH}/trust-policy.json" \ --query Role.Arn --output text) $ echo $ROLE_ARN $ aws iam attach-role-policy --role-name "${ROSA_CLUSTER_NAME}-alb-operator" \ --policy-arn $POLICY_ARN为 AWS Load Balancer Operator 创建一个 secret,以假定我们新创建的 AWS IAM 角色:

$ cat << EOF | oc apply -f - apiVersion: v1 kind: Secret metadata: name: aws-load-balancer-operator namespace: aws-load-balancer-operator stringData: credentials: | [default] role_arn = $ROLE_ARN web_identity_token_file = /var/run/secrets/openshift/serviceaccount/token EOF安装 AWS Load Balancer Operator:

$ cat << EOF | oc apply -f - apiVersion: operators.coreos.com/v1 kind: OperatorGroup metadata: name: aws-load-balancer-operator namespace: aws-load-balancer-operator spec: upgradeStrategy: Default --- apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: aws-load-balancer-operator namespace: aws-load-balancer-operator spec: channel: stable-v1.0 installPlanApproval: Automatic name: aws-load-balancer-operator source: redhat-operators sourceNamespace: openshift-marketplace startingCSV: aws-load-balancer-operator.v1.0.0 EOF使用 Operator 部署 AWS Load Balancer Controller 实例:

注意如果在此处收到错误,等待一分钟并重试,这意味着 Operator 还没有完成安装。

$ cat << EOF | oc apply -f - apiVersion: networking.olm.openshift.io/v1 kind: AWSLoadBalancerController metadata: name: cluster spec: credentials: name: aws-load-balancer-operator EOF检查 Operator 和控制器 pod 是否正在运行:

$ oc -n aws-load-balancer-operator get pods如果没有等待时间并重试,您应该看到以下内容:

NAME READY STATUS RESTARTS AGE aws-load-balancer-controller-cluster-6ddf658785-pdp5d 1/1 Running 0 99s aws-load-balancer-operator-controller-manager-577d9ffcb9-w6zqn 2/2 Running 0 2m4s

2.1.2.1. 验证部署

创建一个新项目:

$ oc new-project hello-world部署 hello world 应用程序:

$ oc new-app -n hello-world --image=docker.io/openshift/hello-openshift为 AWS ALB 配置 NodePort 服务以连接:

$ cat << EOF | oc apply -f - apiVersion: v1 kind: Service metadata: name: hello-openshift-nodeport namespace: hello-world spec: ports: - port: 80 targetPort: 8080 protocol: TCP type: NodePort selector: deployment: hello-openshift EOF使用 AWS Load Balancer Operator 部署 AWS ALB:

$ cat << EOF | oc apply -f - apiVersion: networking.k8s.io/v1 kind: Ingress metadata: name: hello-openshift-alb namespace: hello-world annotations: alb.ingress.kubernetes.io/scheme: internet-facing spec: ingressClassName: alb rules: - http: paths: - path: / pathType: Exact backend: service: name: hello-openshift-nodeport port: number: 80 EOFcurl AWS ALB Ingress 端点,以验证 hello world 应用程序是否可以访问:

注意AWS ALB 置备需要几分钟时间。如果您收到一个错误,显示

curl: (6) Could not resolve host,请等待并重试。$ INGRESS=$(oc -n hello-world get ingress hello-openshift-alb \ -o jsonpath='{.status.loadBalancer.ingress[0].hostname}') $ curl "http://${INGRESS}"输出示例

Hello OpenShift!为您的 hello world 应用程序部署 AWS NLB:

$ cat << EOF | oc apply -f - apiVersion: v1 kind: Service metadata: name: hello-openshift-nlb namespace: hello-world annotations: service.beta.kubernetes.io/aws-load-balancer-type: external service.beta.kubernetes.io/aws-load-balancer-nlb-target-type: instance service.beta.kubernetes.io/aws-load-balancer-scheme: internet-facing spec: ports: - port: 80 targetPort: 8080 protocol: TCP type: LoadBalancer selector: deployment: hello-openshift EOF测试 AWS NLB 端点:

注意NLB 置备需要几分钟时间。如果您收到一个错误,显示

curl: (6) Could not resolve host,请等待并重试。$ NLB=$(oc -n hello-world get service hello-openshift-nlb \ -o jsonpath='{.status.loadBalancer.ingress[0].hostname}') $ curl "http://${NLB}"输出示例

Hello OpenShift!

2.1.3. 删除 AWS Load Balancer Operator 示例安装

删除 hello world 应用命名空间(以及命名空间中的所有资源):

$ oc delete project hello-world删除 AWS Load Balancer Operator 和 AWS IAM 角色:

$ oc delete subscription aws-load-balancer-operator -n aws-load-balancer-operator $ aws iam detach-role-policy \ --role-name "${ROSA_CLUSTER_NAME}-alb-operator" \ --policy-arn $POLICY_ARN $ aws iam delete-role \ --role-name "${ROSA_CLUSTER_NAME}-alb-operator"删除 AWS IAM 策略:

$ aws iam delete-policy --policy-arn $POLICY_ARN

2.2. Red Hat OpenShift Service on AWS 中的 DNS Operator

在 Red Hat OpenShift Service on AWS 中,DNS Operator 会部署和管理 CoreDNS 实例,为集群中的 pod 提供名称解析服务,启用基于 DNS 的 Kubernetes 服务发现,并解析内部 cluster.local 名称。

2.2.1. 使用 DNS 转发

您可以使用以下方法使用 DNS 转发来覆盖 /etc/resolv.conf 文件中的默认转发配置:

为每个区指定名称服务器 (

spec.servers)。如果转发区是由 Red Hat OpenShift Service on AWS 管理的入口域,则必须为域授权上游名称服务器。重要您必须至少指定一个区。否则,集群可能会丢失功能。

-

提供上游 DNS 服务器列表 (

spec.upstreamResolvers)。 - 更改默认转发策略。

默认域的 DNS 转发配置可以同时在 /etc/resolv.conf 文件和上游 DNS 服务器中指定默认服务器。

流程

修改名为

default的 DNS Operator 对象:$ oc edit dns.operator/default发出上一命令后,Operator 会根据

spec.servers创建并更新名为dns-default的配置映射,并使用额外的服务器配置块。重要当为

zones参数指定值时,请确保只转发到特定区域,如您的内网。您必须至少指定一个区。否则,集群可能会丢失功能。如果任何服务器都没有与查询匹配的区域,则名称解析会返回上游 DNS 服务器。

配置 DNS 转发

apiVersion: operator.openshift.io/v1 kind: DNS metadata: name: default spec: cache: negativeTTL: 0s positiveTTL: 0s logLevel: Normal nodePlacement: {} operatorLogLevel: Normal servers: - name: example-server1 zones: - example.com2 forwardPlugin: policy: Random3 upstreams:4 - 1.1.1.1 - 2.2.2.2:5353 upstreamResolvers:5 policy: Random6 protocolStrategy: ""7 transportConfig: {}8 upstreams: - type: SystemResolvConf9 - type: Network address: 1.2.3.410 port: 5311 status: clusterDomain: cluster.local clusterIP: x.y.z.10 conditions: ...- 1

- 必须符合

rfc6335服务名称语法。 - 2

- 必须符合

rfc1123服务名称语法中的子域的定义。集群域cluster.local是对zones字段的无效子域。 - 3

- 定义用于选择

forwardPlugin中列出的上游解析器的策略。默认值为Random。您还可以使用RoundRobin, 和Sequential值。 - 4

- 每个

forwardPlugin最多允许 15 个upstreams。 - 5

- 您可以使用

upstreamResolvers覆盖默认转发策略,并将 DNS 解析转发到默认域的指定 DNS 解析器(上游解析器)。如果没有提供任何上游解析器,DNS 名称查询将进入/etc/resolv.conf中声明的服务器。 - 6

- 决定选择上游中列出的

upstreams服务器进行查询的顺序。您可以指定这些值之一:Random、RoundRobin或Sequential。默认值为Sequential。 - 7

- 如果被省略,平台会选择一个默认值,通常是原始客户端请求的协议。设置为

TCP,以指定平台应该对所有上游 DNS 请求使用 TCP,即使客户端请求使用了 UDP。 - 8

- 用于配置传输类型、服务器名称和可选自定义 CA 或 CA 捆绑包,以便在将 DNS 请求转发到上游解析器时使用。

- 9

- 您可以指定两个类型的

upstreams:SystemResolvConf或Network。SystemResolvConf将上游配置为使用/etc/resolv.conf和Network定义一个Networkresolver。您可以指定其中一个或两者都指定。 - 10

- 如果指定类型是

Network,则必须提供 IP 地址。address字段必须是有效的 IPv4 或 IPv6 地址。 - 11

- 如果指定类型是

Network,您可以选择性地提供端口。port字段必须是1到65535之间的值。如果您没有为上游指定端口,则默认端口为 853。

Ingress Operator 实现 IngressController API,是负责启用对 Red Hat OpenShift Service on AWS 集群服务的外部访问的组件。

在创建 Red Hat OpenShift Service on AWS 集群时,在集群中运行的 Pod 和服务会各自分配自己的 IP 地址。IP 地址可供附近运行的其他容器集和服务访问,但外部客户端无法访问这些 IP 地址。

Ingress Operator 通过部署和管理一个或多个基于 HAProxy 的 Ingress Controller 来处理路由,使外部客户端可以访问您的服务。Red Hat Site Reliability Engineers (SRE) 为 Red Hat OpenShift Service on AWS 管理 Ingress Operator。虽然您无法更改 Ingress Operator 的设置,但您可以查看默认的 Ingress Controller 配置、状态和日志以及 Ingress Operator 状态。

2.3.2. Ingress 配置资产

安装程序在 config.openshift.io API 组中生成带有 Ingress 资源的资产,cluster-ingress-02-config.yml。

Ingress 资源的 YAML 定义

apiVersion: config.openshift.io/v1

kind: Ingress

metadata:

name: cluster

spec:

domain: apps.openshiftdemos.com

安装程序将这个资产保存在 manifests/ 目录下的 cluster-ingress-02-config.yml 文件中。此 Ingress 资源定义 Ingress 的集群范围配置。此 Ingress 配置的用法如下所示:

- Ingress Operator 使用集群 Ingress 配置中的域,作为默认 Ingress Controller 的域。

-

OpenShift API Server Operator 使用集群 Ingress 配置中的域。在为未指定显式主机的

Route资源生成默认主机时,还会使用此域。

2.3.3. Ingress Controller 配置参数

IngressController 自定义资源(CR)包含可选配置参数,您可以配置它们来满足您的机构的特定需求。

| 参数 | 描述 |

|---|---|

|

|

如果为空,默认值为 |

|

|

|

|

|

对于云环境,使用

您可以配置以下

如果没有设置,则默认值基于

|

|

|

secret 必须包含以下密钥和数据:*

如果没有设置,则自动生成和使用通配符证书。该证书对 Ingress Controller 的 内部证书(无论是生成的证书还是用户指定的证书)自动与 AWS 内置 OAuth 服务器上的 Red Hat OpenShift Service 集成。 |

|

|

|

|

|

|

|

|

如果没有设置,则使用默认值。 注意

|

|

|

如果没有设置,则默认值基于

当使用

Ingress Controller 的最低 TLS 版本是 注意

加密器和配置的安全配置集的最小 TLS 版本反映在 重要

Ingress Operator 将 |

|

|

|

|

|

|

|

|

|

|

|

通过为

默认情况下,策略设置为

通过设置 这些调整仅应用于明文、边缘终止和重新加密路由,且仅在使用 HTTP/1 时有效。

对于请求标头,这些调整仅适用于具有

|

|

|

|

|

|

|

|

|

对于您要捕获的任何 Cookie,以下参数必须位于

例如: |

|

|

|

|

|

|

|

|

|

|

|

这些连接来自负载均衡器健康探测或 Web 浏览器规范连接(预连接),可以安全地忽略。但是,这些请求可能是由网络错误造成的,因此将此字段设置为 |

2.3.3.1. Ingress Controller TLS 安全配置集

TLS 安全配置文件为服务器提供了一种方式,以规范连接的客户端在连接服务器时可以使用哪些密码。

2.3.3.1.1. 了解 TLS 安全配置集

您可以使用 TLS (传输层安全)安全配置集定义各种 Red Hat OpenShift Service on AWS 组件需要哪些 TLS 密码。Red Hat OpenShift Service on AWS TLS 安全配置集基于 Mozilla 推荐的配置。

您可以为每个组件指定以下 TLS 安全配置集之一:

| profile | 描述 |

|---|---|

|

| 此配置集用于旧的客户端或库。该配置集基于旧的向后兼容性建议配置。

注意 对于 Ingress Controller,最小 TLS 版本从 1.0 转换为 1.1。 |

|

| 此配置集是 Ingress Controller、kubelet 和 control plane 的默认 TLS 安全配置集。该配置集基于 Intermediate 兼容性推荐的配置。

注意 这个配置集是大多数客户端的建议配置。 |

|

| 此配置集主要用于不需要向后兼容的现代客户端。这个配置集基于 Modern 兼容性推荐的配置。

|

|

| 此配置集允许您定义要使用的 TLS 版本和密码。 警告

使用 |

当使用预定义的配置集类型时,有效的配置集配置可能会在发行版本之间有所改变。例如,使用在版本 X.Y.Z 中部署的 Intermediate 配置集指定了一个规格,升级到版本 X.Y.Z+1 可能会导致应用新的配置集配置,从而导致推出部署。

2.3.3.1.2. 为 Ingress Controller 配置 TLS 安全配置集

要为 Ingress Controller 配置 TLS 安全配置集,请编辑 IngressController 自定义资源(CR)来指定预定义或自定义 TLS 安全配置集。如果没有配置 TLS 安全配置集,则默认值基于为 API 服务器设置的 TLS 安全配置集。

配置 Old TLS 安全配置集的 IngressController CR 示例

apiVersion: operator.openshift.io/v1

kind: IngressController

...

spec:

tlsSecurityProfile:

old: {}

type: Old

...TLS 安全配置集定义 Ingress Controller 的 TLS 连接的最低 TLS 版本和 TLS 密码。

您可以在 Status.Tls Profile 和 Spec.Tls Security Profile 下看到 IngressController 自定义资源(CR)中配置的 TLS 安全配置集的密码和最小 TLS 版本。对于 Custom TLS 安全配置集,这两个参数下列出了特定的密码和最低 TLS 版本。

HAProxy Ingress Controller 镜像支持 TLS 1.3 和 Modern 配置集。

Ingress Operator 还会将 Old 或 Custom 配置集的 TLS 1.0 转换为 1.1。

先决条件

-

您可以使用具有

cluster-admin角色的用户访问集群。

流程

编辑

openshift-ingress-operator项目中的IngressControllerCR,以配置 TLS 安全配置集:$ oc edit IngressController default -n openshift-ingress-operator添加

spec.tlsSecurityProfile字段:Custom配置集的IngressControllerCR 示例apiVersion: operator.openshift.io/v1 kind: IngressController ... spec: tlsSecurityProfile: type: Custom1 custom:2 ciphers:3 - ECDHE-ECDSA-CHACHA20-POLY1305 - ECDHE-RSA-CHACHA20-POLY1305 - ECDHE-RSA-AES128-GCM-SHA256 - ECDHE-ECDSA-AES128-GCM-SHA256 minTLSVersion: VersionTLS11 ...- 保存文件以使改变生效。

验证

验证

IngressControllerCR 中是否设置了配置集:$ oc describe IngressController default -n openshift-ingress-operator输出示例

Name: default Namespace: openshift-ingress-operator Labels: <none> Annotations: <none> API Version: operator.openshift.io/v1 Kind: IngressController ... Spec: ... Tls Security Profile: Custom: Ciphers: ECDHE-ECDSA-CHACHA20-POLY1305 ECDHE-RSA-CHACHA20-POLY1305 ECDHE-RSA-AES128-GCM-SHA256 ECDHE-ECDSA-AES128-GCM-SHA256 Min TLS Version: VersionTLS11 Type: Custom ...

2.3.3.1.3. 配置 mutual TLS 身份验证

您可以通过设置 spec.clientTLS 值,将 Ingress Controller 配置为启用 mutual TLS (mTLS) 身份验证。clientTLS 值将 Ingress Controller 配置为验证客户端证书。此配置包括设置 clientCA 值,这是对配置映射的引用。配置映射包含 PEM 编码的 CA 证书捆绑包,用于验证客户端的证书。另外,您还可以配置证书主题过滤器列表。

如果 clientCA 值指定了 X509v3 证书撤销列表 (CRL) 分发点,Ingress Operator 会下载并管理基于每个提供的证书中指定的 HTTP URI X509v3 CRL 分发点的 CRL 配置映射。Ingress Controller 在 mTLS/TLS 协商过程中使用此配置映射。不提供有效证书的请求将被拒绝。

先决条件

-

您可以使用具有

cluster-admin角色的用户访问集群。 - 您有一个 PEM 编码的 CA 证书捆绑包。

如果您的 CA 捆绑包引用 CRL 发布点,还必须将最终用户或叶证书包含在客户端 CA 捆绑包中。此证书必须在

CRL 分发点下包含 HTTP URI,如 RFC 5280 所述。例如:Issuer: C=US, O=Example Inc, CN=Example Global G2 TLS RSA SHA256 2020 CA1 Subject: SOME SIGNED CERT X509v3 CRL Distribution Points: Full Name: URI:http://crl.example.com/example.crl

流程

在

openshift-config命名空间中,从 CA 捆绑包创建配置映射:$ oc create configmap \ router-ca-certs-default \ --from-file=ca-bundle.pem=client-ca.crt \1 -n openshift-config- 1

- 配置映射数据键必须是

ca-bundle.pem,数据值必须是 PEM 格式的 CA 证书。

编辑

openshift-ingress-operator项目中的IngressController资源:$ oc edit IngressController default -n openshift-ingress-operator添加

spec.clientTLS字段和子字段来配置 mutual TLS:指定过滤模式的

clientTLS配置集的IngressControllerCR 示例apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: clientTLS: clientCertificatePolicy: Required clientCA: name: router-ca-certs-default allowedSubjectPatterns: - "^/CN=example.com/ST=NC/C=US/O=Security/OU=OpenShift$"-

可选,输入以下命令获取

允许的SubjectPatterns的可辨识名称(DN)。

$ openssl x509 -in custom-cert.pem -noout -subject

subject= /CN=example.com/ST=NC/C=US/O=Security/OU=OpenShift2.3.4. 查看默认的 Ingress Controller

Ingress Operator 是 Red Hat OpenShift Service on AWS 的一个核心功能,开箱即用。

每个 Red Hat OpenShift Service on AWS 新安装都有一个名为 default 的 ingresscontroller。它可以通过额外的 Ingress Controller 来补充。如果删除了默认的 ingresscontroller,Ingress Operator 会在一分钟内自动重新创建。

流程

查看默认的 Ingress Controller:

$ oc describe --namespace=openshift-ingress-operator ingresscontroller/default

2.3.5. 查看 Ingress Operator 状态

您可以查看并检查 Ingress Operator 的状态。

流程

查看您的 Ingress Operator 状态:

$ oc describe clusteroperators/ingress

2.3.6. 查看 Ingress Controller 日志

您可以查看 Ingress Controller 日志。

流程

查看 Ingress Controller 日志:

$ oc logs --namespace=openshift-ingress-operator deployments/ingress-operator -c <container_name>

2.3.7. 查看 Ingress Controller 状态

您可以查看特定 Ingress Controller 的状态。

流程

查看 Ingress Controller 的状态:

$ oc describe --namespace=openshift-ingress-operator ingresscontroller/<name>

2.3.8. 创建自定义 Ingress Controller

作为集群管理员,您可以创建新的自定义 Ingress Controller。因为默认 Ingress Controller 在 Red Hat OpenShift Service on AWS 更新过程中可能会改变,因此当维护在集群更新过程中保留的配置时,创建自定义 Ingress Controller 非常有用。

这个示例为自定义 Ingress Controller 提供最小规格。要进一步定制您的自定义 Ingress Controller,请参阅"配置 Ingress Controller"。

前提条件

-

安装 OpenShift CLI (

oc) 。 -

以具有

cluster-admin特权的用户身份登录。

流程

创建定义自定义

IngressController对象的 YAML 文件:custom-ingress-controller.yaml文件示例apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: <custom_name>1 namespace: openshift-ingress-operator spec: defaultCertificate: name: <custom-ingress-custom-certs>2 replicas: 13 domain: <custom_domain>4 运行以下命令来创建对象:

$ oc create -f custom-ingress-controller.yaml

2.3.9. 配置 Ingress Controller

2.3.9.1. 设置自定义默认证书

作为管理员,您可以通过创建 Secret 资源并编辑 IngressController 自定义资源 (CR),将 Ingress Controller 配置为使用自定义证书。

前提条件

- 您必须在 PEM 编码文件中有一个证书/密钥对,其中该证书由可信证书认证机构签名,或者由您在一个自定义 PKI 中配置的私有可信证书认证机构签名。

您的证书满足以下要求:

- 该证书对入口域有效。

-

证书使用

subjectAltName扩展来指定通配符域,如*.apps.ocp4.example.com。

您必须有一个

IngressControllerCR。您可以使用默认值:$ oc --namespace openshift-ingress-operator get ingresscontrollers输出示例

NAME AGE default 10m

如果您有中间证书,则必须将其包含在包含自定义默认证书的 secret 的 tls.crt 文件中。指定证书时指定的顺序是相关的; 在任意服务器证书后列出您的中间证书。

流程

以下步骤假定自定义证书和密钥对位于当前工作目录下的 tls.crt 和 tls.key 文件中。替换 tls.crt 和 tls.key 的实际路径名。在创建 Secret 资源并在 IngressController CR 中引用它时,您也可以将 custom-certs-default 替换成另一名称。

此操作会导致使用滚动部署策略重新部署 Ingress Controller。

使用

tls.crt和tls.key文件,创建在openshift-ingress命名空间中包含自定义证书的 Secret 资源。$ oc --namespace openshift-ingress create secret tls custom-certs-default --cert=tls.crt --key=tls.key更新 IngressController CR,以引用新的证书 Secret:

$ oc patch --type=merge --namespace openshift-ingress-operator ingresscontrollers/default \ --patch '{"spec":{"defaultCertificate":{"name":"custom-certs-default"}}}'验证更新是否已生效:

$ echo Q |\ openssl s_client -connect console-openshift-console.apps.<domain>:443 -showcerts 2>/dev/null |\ openssl x509 -noout -subject -issuer -enddate其中:

<domain>- 指定集群的基域名。

输出示例

subject=C = US, ST = NC, L = Raleigh, O = RH, OU = OCP4, CN = *.apps.example.com issuer=C = US, ST = NC, L = Raleigh, O = RH, OU = OCP4, CN = example.com notAfter=May 10 08:32:45 2022 GM提示您还可以应用以下 YAML 来设置自定义默认证书:

apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: defaultCertificate: name: custom-certs-default证书 Secret 名称应该与用来更新 CR 的值匹配。

修改了 IngressController CR 后,Ingress Operator 将更新 Ingress Controller 的部署以使用自定义证书。

2.3.9.2. 删除自定义默认证书

作为管理员,您可以删除配置了 Ingress Controller 的自定义证书。

前提条件

-

您可以使用具有

cluster-admin角色的用户访问集群。 -

已安装 OpenShift CLI(

oc)。 - 您之前为 Ingress Controller 配置了自定义默认证书。

流程

要删除自定义证书并恢复 Red Hat OpenShift Service on AWS 附带的证书,请输入以下命令:

$ oc patch -n openshift-ingress-operator ingresscontrollers/default \ --type json -p $'- op: remove\n path: /spec/defaultCertificate'集群协调新证书配置时可能会有延迟。

验证

要确认原始集群证书已被恢复,请输入以下命令:

$ echo Q | \ openssl s_client -connect console-openshift-console.apps.<domain>:443 -showcerts 2>/dev/null | \ openssl x509 -noout -subject -issuer -enddate其中:

<domain>- 指定集群的基域名。

输出示例

subject=CN = *.apps.<domain> issuer=CN = ingress-operator@1620633373 notAfter=May 10 10:44:36 2023 GMT

2.3.9.3. 自动扩展 Ingress Controller

您可以自动扩展 Ingress Controller 以动态满足路由性能或可用性要求,如提高吞吐量的要求。

以下流程提供了扩展默认 Ingress Controller 的示例。

前提条件

-

已安装 OpenShift CLI (

oc)。 -

您可以使用具有

cluster-admin角色的用户访问 Red Hat OpenShift Service on AWS 集群。 已安装自定义 Metrics Autoscaler Operator 和关联的 KEDA Controller。

-

您可以在 Web 控制台中使用 OperatorHub 安装 Operator。安装 Operator 后,您可以创建

KedaController实例。

-

您可以在 Web 控制台中使用 OperatorHub 安装 Operator。安装 Operator 后,您可以创建

流程

运行以下命令,创建一个服务帐户来与 Thanos 进行身份验证:

$ oc create -n openshift-ingress-operator serviceaccount thanos && oc describe -n openshift-ingress-operator serviceaccount thanos输出示例

Name: thanos Namespace: openshift-ingress-operator Labels: <none> Annotations: <none> Image pull secrets: thanos-dockercfg-kfvf2 Mountable secrets: thanos-dockercfg-kfvf2 Tokens: <none> Events: <none>使用以下命令手动创建服务帐户令牌:

$ oc apply -f - <<EOF apiVersion: v1 kind: Secret metadata: name: thanos-token namespace: openshift-ingress-operator annotations: kubernetes.io/service-account.name: thanos type: kubernetes.io/service-account-token EOF使用服务帐户的令牌,在

openshift-ingress-operator命名空间中定义一个TriggerAuthentication对象。创建

TriggerAuthentication对象,并将secret变量的值传递给TOKEN参数:$ oc apply -f - <<EOF apiVersion: keda.sh/v1alpha1 kind: TriggerAuthentication metadata: name: keda-trigger-auth-prometheus namespace: openshift-ingress-operator spec: secretTargetRef: - parameter: bearerToken name: thanos-token key: token - parameter: ca name: thanos-token key: ca.crt EOF

创建并应用角色以从 Thanos 读取指标:

创建一个新角色

thanos-metrics-reader.yaml,从 pod 和节点读取指标:thanos-metrics-reader.yaml

apiVersion: rbac.authorization.k8s.io/v1 kind: Role metadata: name: thanos-metrics-reader namespace: openshift-ingress-operator rules: - apiGroups: - "" resources: - pods - nodes verbs: - get - apiGroups: - metrics.k8s.io resources: - pods - nodes verbs: - get - list - watch - apiGroups: - "" resources: - namespaces verbs: - get运行以下命令来应用新角色:

$ oc apply -f thanos-metrics-reader.yaml

输入以下命令在服务帐户中添加新角色:

$ oc adm policy -n openshift-ingress-operator add-role-to-user thanos-metrics-reader -z thanos --role-namespace=openshift-ingress-operator$ oc adm policy -n openshift-ingress-operator add-cluster-role-to-user cluster-monitoring-view -z thanos注意只有在使用跨命名空间查询时,才需要参数

add-cluster-role-to-user。以下步骤使用kube-metrics命名空间中的查询,该命名空间需要此参数。创建一个新的

ScaledObjectYAML 文件ingress-autoscaler.yaml,该文件以默认 Ingress Controller 部署为目标:ScaledObject定义示例apiVersion: keda.sh/v1alpha1 kind: ScaledObject metadata: name: ingress-scaler namespace: openshift-ingress-operator spec: scaleTargetRef:1 apiVersion: operator.openshift.io/v1 kind: IngressController name: default envSourceContainerName: ingress-operator minReplicaCount: 1 maxReplicaCount: 202 cooldownPeriod: 1 pollingInterval: 1 triggers: - type: prometheus metricType: AverageValue metadata: serverAddress: https://thanos-querier.openshift-monitoring.svc.cluster.local:90913 namespace: openshift-ingress-operator4 metricName: 'kube-node-role' threshold: '1' query: 'sum(kube_node_role{role="worker",service="kube-state-metrics"})'5 authModes: "bearer" authenticationRef: name: keda-trigger-auth-prometheus重要如果使用跨命名空间查询,您必须在

serverAddress字段中目标端口 9091 而不是端口 9092。您还必须有升级的特权,才能从此端口读取指标。运行以下命令来应用自定义资源定义:

$ oc apply -f ingress-autoscaler.yaml

验证

运行以下命令,验证默认 Ingress Controller 是否已扩展以匹配

kube-state-metrics查询返回的值:使用

grep命令搜索 Ingress Controller YAML 文件以查找副本:$ oc get -n openshift-ingress-operator ingresscontroller/default -o yaml | grep replicas:输出示例

replicas: 3获取

openshift-ingress项目中的 pod:$ oc get pods -n openshift-ingress输出示例

NAME READY STATUS RESTARTS AGE router-default-7b5df44ff-l9pmm 2/2 Running 0 17h router-default-7b5df44ff-s5sl5 2/2 Running 0 3d22h router-default-7b5df44ff-wwsth 2/2 Running 0 66s

2.3.9.4. 扩展 Ingress Controller

手动扩展 Ingress Controller 以满足路由性能或可用性要求,如提高吞吐量的要求。oc 命令用于扩展 IngressController 资源。以下流程提供了扩展默认 IngressController 的示例。

扩展不是立刻就可以完成的操作,因为它需要时间来创建所需的副本数。

流程

查看默认

IngressController的当前可用副本数:$ oc get -n openshift-ingress-operator ingresscontrollers/default -o jsonpath='{$.status.availableReplicas}'输出示例

2使用

oc patch命令,将默认IngressController扩展至所需的副本数。以下示例将默认IngressController扩展至 3 个副本:$ oc patch -n openshift-ingress-operator ingresscontroller/default --patch '{"spec":{"replicas": 3}}' --type=merge输出示例

ingresscontroller.operator.openshift.io/default patched验证默认

IngressController是否已扩展至您指定的副本数:$ oc get -n openshift-ingress-operator ingresscontrollers/default -o jsonpath='{$.status.availableReplicas}'输出示例

3提示您还可以应用以下 YAML 将 Ingress Controller 扩展为三个副本:

apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: replicas: 31 - 1

- 如果需要不同数量的副本,请更改

replicas值。

2.3.9.5. 配置 Ingress 访问日志

您可以配置 Ingress Controller 以启用访问日志。如果您的集群没有接收许多流量,那么您可以将日志记录到 sidecar。如果您有高流量集群,为了避免超过日志记录堆栈的容量,或者与 Red Hat OpenShift Service on AWS 之外的日志记录基础架构集成,您可以将日志转发到自定义 syslog 端点。您还可以指定访问日志的格式。

当不存在 Syslog 日志记录基础架构时,容器日志记录可用于在低流量集群中启用访问日志,或者在诊断 Ingress Controller 时进行简短使用。

对于访问日志可能会超过 OpenShift Logging 堆栈容量的高流量集群,或需要任何日志记录解决方案与现有 Syslog 日志记录基础架构集成的环境,则需要 syslog。Syslog 用例可能会相互重叠。

前提条件

-

以具有

cluster-admin特权的用户身份登录。

流程

配置 Ingress 访问日志到 sidecar。

要配置 Ingress 访问日志记录,您必须使用

spec.logging.access.destination指定一个目的地。要将日志记录指定到 sidecar 容器,您必须指定Containerspec.logging.access.destination.type。以下示例是将日志记录到Container目的地的 Ingress Controller 定义:apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: replicas: 2 logging: access: destination: type: Container当将 Ingress Controller 配置为日志记录到 sidecar 时,Operator 会在 Ingress Controller Pod 中创建一个名为

logs的容器:$ oc -n openshift-ingress logs deployment.apps/router-default -c logs输出示例

2020-05-11T19:11:50.135710+00:00 router-default-57dfc6cd95-bpmk6 router-default-57dfc6cd95-bpmk6 haproxy[108]: 174.19.21.82:39654 [11/May/2020:19:11:50.133] public be_http:hello-openshift:hello-openshift/pod:hello-openshift:hello-openshift:10.128.2.12:8080 0/0/1/0/1 200 142 - - --NI 1/1/0/0/0 0/0 "GET / HTTP/1.1"

配置 Ingress 访问日志记录到 Syslog 端点。

要配置 Ingress 访问日志记录,您必须使用

spec.logging.access.destination指定一个目的地。要将日志记录指定到 Syslog 端点目的地,您必须为spec.logging.access.destination.type指定Syslog。如果目的地类型是Syslog,还必须使用spec.logging.access.destination.syslog.address指定目标端点,您可以使用spec.logging.access.destination.syslog.facility指定一个工具。以下示例是将日志记录到Syslog目的地的 Ingress Controller 定义:apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: replicas: 2 logging: access: destination: type: Syslog syslog: address: 1.2.3.4 port: 10514注意Syslog目的地端口必须是 UDP。syslog目标地址必须是 IP 地址。它不支持 DNS 主机名。

使用特定的日志格式配置 Ingress 访问日志。

您可以指定

spec.logging.access.httpLogFormat来自定义日志格式。以下示例是一个 Ingress Controller 定义,它将日志记录到 IP 地址为 1.2.3.4、端口为 10514 的syslog端点:apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: replicas: 2 logging: access: destination: type: Syslog syslog: address: 1.2.3.4 port: 10514 httpLogFormat: '%ci:%cp [%t] %ft %b/%s %B %bq %HM %HU %HV'

禁用 Ingress 访问日志。

要禁用 Ingress 访问日志,请保留

spec.logging或spec.logging.access为空:apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: replicas: 2 logging: access: null

允许 Ingress Controller 在使用 sidecar 时,修改 HAProxy 日志长度。

如果您使用

spec.logging.access.destination.syslog.maxLength,请使用spec.logging.access.destination.type: Syslog。apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: replicas: 2 logging: access: destination: type: Syslog syslog: address: 1.2.3.4 maxLength: 4096 port: 10514如果您使用

spec.logging.access.destination.container.maxLength,请使用spec.logging.access.destination.type: Container。apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: replicas: 2 logging: access: destination: type: Container container: maxLength: 8192

2.3.9.6. 设置 Ingress Controller 线程数

集群管理员可设置线程数,以增加集群可以处理的入站的连接量。您可以修补现有的 Ingress Controller 来增加线程量。

前提条件

- 以下假设您已创建了 Ingress Controller。

流程

更新 Ingress Controller 以增加线程数量:

$ oc -n openshift-ingress-operator patch ingresscontroller/default --type=merge -p '{"spec":{"tuningOptions": {"threadCount": 8}}}'注意如果您的节点有能力运行大量资源,您可以使用与预期节点容量匹配的标签配置

spec.nodePlacement.nodeSelector,并将spec.tuningOptions.threadCount配置为一个适当的高值。

2.3.9.7. 配置 Ingress Controller 以使用内部负载均衡器

当在云平台上创建 Ingress Controller 时,Ingress Controller 默认由一个公共云负载均衡器发布。作为管理员,您可以创建一个使用内部云负载均衡器的 Ingress Controller。

如果要更改 IngressController 的 scope,您可以在创建自定义资源(CR)后更改 .spec.endpointPublishingStrategy.loadBalancer.scope 参数。

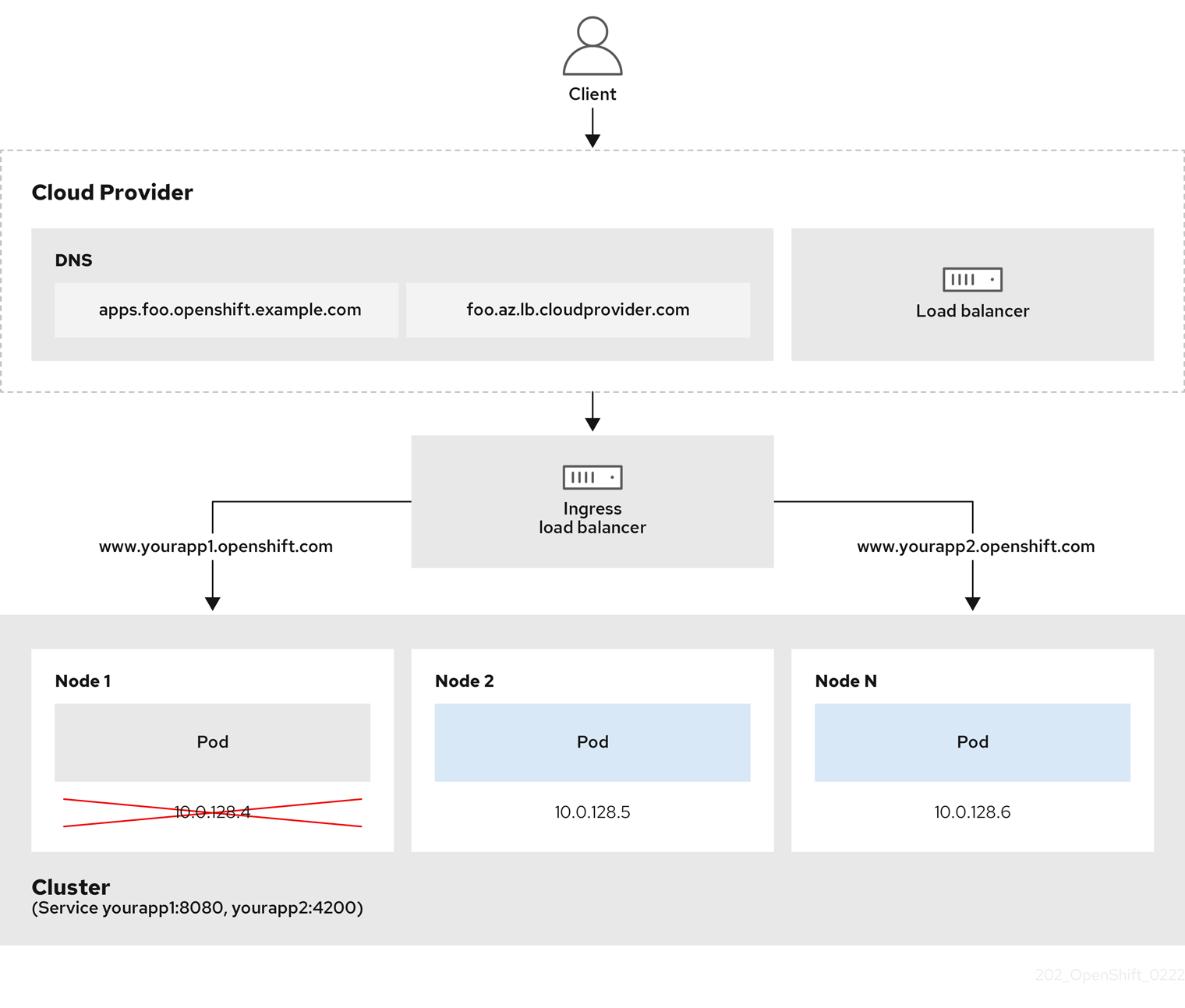

图 2.1. LoadBalancer 图表

上图显示了与 AWS Ingress LoadBalancerService 端点发布策略相关的 Red Hat OpenShift Service 的以下概念:

- 您可以使用 OpenShift Ingress Controller Load Balancer 在外部使用云供应商负载均衡器或内部加载负载。

- 您可以使用负载均衡器的单个 IP 地址以及更熟悉的端口,如 8080 和 4200,如图形中所述的集群所示。

- 来自外部负载均衡器的流量定向到 pod,并由负载均衡器管理,如下节点的实例中所述。有关实现详情请查看 Kubernetes 服务文档 。

前提条件

-

安装 OpenShift CLI (

oc) 。 -

以具有

cluster-admin特权的用户身份登录。

流程

在名为

<name>-ingress-controller.yaml的文件中创建IngressController自定义资源 (CR) ,如下例所示:apiVersion: operator.openshift.io/v1 kind: IngressController metadata: namespace: openshift-ingress-operator name: <name>1 spec: domain: <domain>2 endpointPublishingStrategy: type: LoadBalancerService loadBalancer: scope: Internal3 运行以下命令,创建上一步中定义的 Ingress Controller:

$ oc create -f <name>-ingress-controller.yaml1 - 1

- 将

<name>替换为IngressController对象的名称。

可选:通过运行以下命令确认创建了 Ingress Controller:

$ oc --all-namespaces=true get ingresscontrollers

2.3.9.8. 设置 Ingress Controller 健康检查间隔

集群管理员可以设置健康检查间隔,以定义路由器在两个连续健康检查之间等待的时间。这个值会作为所有路由的默认值进行全局应用。默认值为 5 秒。

先决条件

- 以下假设您已创建了 Ingress Controller。

流程

更新 Ingress Controller,以更改后端健康检查之间的间隔:

$ oc -n openshift-ingress-operator patch ingresscontroller/default --type=merge -p '{"spec":{"tuningOptions": {"healthCheckInterval": "8s"}}}'注意要覆盖单个路由的

healthCheckInterval,请使用路由注解router.openshift.io/haproxy.health.check.interval

2.3.9.9. 将集群的默认 Ingress Controller 配置为内部

您可以通过删除并重新它来将默认 Ingress Controller 配置为内部。

如果要更改 IngressController 的 scope,您可以在创建自定义资源(CR)后更改 .spec.endpointPublishingStrategy.loadBalancer.scope 参数。

先决条件

-

安装 OpenShift CLI(

oc)。 -

以具有

cluster-admin特权的用户身份登录。

流程

通过删除并重新创建集群,将

默认Ingress Controller 配置为内部。$ oc replace --force --wait --filename - <<EOF apiVersion: operator.openshift.io/v1 kind: IngressController metadata: namespace: openshift-ingress-operator name: default spec: endpointPublishingStrategy: type: LoadBalancerService loadBalancer: scope: Internal EOF

2.3.9.10. 配置路由准入策略

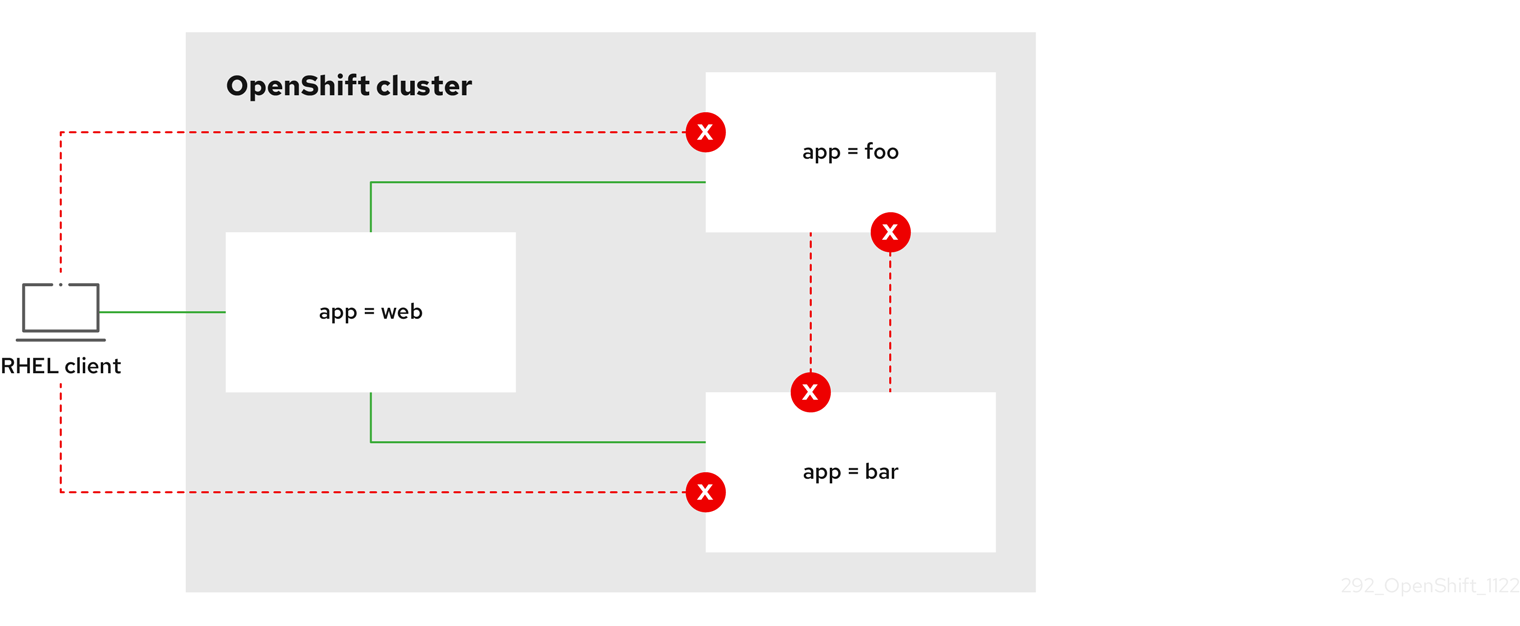

管理员和应用程序开发人员可在多个命名空间中运行具有相同域名的应用程序。这是针对多个团队开发的、在同一个主机名上公开的微服务的机构。

只有在命名空间间有信任的集群才会启用跨命名空间之间的声明,否则恶意用户可能会接管主机名。因此,默认的准入策略不允许在命名空间间声明主机名。

先决条件

- 必须具有集群管理员权限。

流程

使用以下命令编辑

ingresscontroller资源变量的.spec.routeAdmission 字段:$ oc -n openshift-ingress-operator patch ingresscontroller/default --patch '{"spec":{"routeAdmission":{"namespaceOwnership":"InterNamespaceAllowed"}}}' --type=mergeIngress 控制器配置参数

spec: routeAdmission: namespaceOwnership: InterNamespaceAllowed ...提示您还可以应用以下 YAML 来配置路由准入策略:

apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: routeAdmission: namespaceOwnership: InterNamespaceAllowed

2.3.9.11. 使用通配符路由

HAProxy Ingress Controller 支持通配符路由。Ingress Operator 使用 wildcardPolicy 来配置 Ingress Controller 的 ROUTER_ALLOW_WILDCARD_ROUTES 环境变量。

Ingress Controller 的默认行为是接受采用 None 通配符策略的路由,该策略与现有 IngressController 资源向后兼容。

流程

配置通配符策略。

使用以下命令来编辑

IngressController资源:$ oc edit IngressController在

spec下,将wildcardPolicy字段设置为 WildcardsDisallowed或WildcardsAllowed:spec: routeAdmission: wildcardPolicy: WildcardsDisallowed # or WildcardsAllowed

2.3.9.12. HTTP 标头配置

Red Hat OpenShift Service on AWS 提供了使用 HTTP 标头的不同方法。在设置或删除标头时,您可以使用 Ingress Controller 中的特定字段或单独的路由来修改请求和响应标头。您还可以使用路由注解设置某些标头。配置标头的各种方法在协同工作时可能会带来挑战。

您只能在 IngressController 或 Route CR 中设置或删除标头,您无法附加它们。如果使用值设置 HTTP 标头,则该值必须已完成,且在以后不需要附加。在附加标头(如 X-Forwarded-For 标头)时,请使用 spec.httpHeaders.forwardedHeaderPolicy 字段,而不是 spec.httpHeaders.actions。

2.3.9.12.1. 优先级顺序

当在 Ingress Controller 和路由中修改相同的 HTTP 标头时,HAProxy 会根据它是请求还是响应标头来优先选择操作。

- 对于 HTTP 响应标头,Ingress Controller 中指定的操作会在路由中指定的操作后执行。这意味着 Ingress Controller 中指定的操作具有优先权。

- 对于 HTTP 请求标头,路由中指定的操作会在 Ingress Controller 中指定的操作后执行。这意味着路由中指定的操作具有优先权。

例如,集群管理员使用以下配置设置 X-Frame-Options 响应标头,其值为 DENY :

IngressController spec 示例

apiVersion: operator.openshift.io/v1

kind: IngressController

# ...

spec:

httpHeaders:

actions:

response:

- name: X-Frame-Options

action:

type: Set

set:

value: DENY

路由所有者设置 Ingress Controller 中设置的相同响应标头,但使用以下配置值 SAMEORIGIN :

Route 规格示例

apiVersion: route.openshift.io/v1

kind: Route

# ...

spec:

httpHeaders:

actions:

response:

- name: X-Frame-Options

action:

type: Set

set:

value: SAMEORIGIN

当 IngressController spec 和 Route spec 都配置 X-Frame-Options 标头时,Ingress Controller 中的全局级别为这个标头设置的值将具有优先权,即使一个特定的路由允许帧。对于请求标头,Route spec 值会覆盖 IngressController spec 值。

发生这个优先级,因为 haproxy.config 文件使用以下逻辑,其中 Ingress Controller 被视为前端,单独的路由被视为后端。应用到前端配置的标头值 DENY 使用后端中设置的值 SAMEORIGIN 覆盖相同的标头:

frontend public

http-response set-header X-Frame-Options 'DENY'

frontend fe_sni

http-response set-header X-Frame-Options 'DENY'

frontend fe_no_sni

http-response set-header X-Frame-Options 'DENY'

backend be_secure:openshift-monitoring:alertmanager-main

http-response set-header X-Frame-Options 'SAMEORIGIN'另外,Ingress Controller 或路由中定义的任何操作都覆盖使用路由注解设置的值。

2.3.9.12.2. 特殊情况标头

以下标头可能会阻止完全被设置或删除,或者在特定情况下允许:

| 标头名称 | 使用 IngressController spec 进行配置 | 使用 Route 规格进行配置 | 禁止的原因 | 使用其他方法进行配置 |

|---|---|---|---|---|

|

| 否 | 否 |

| 否 |

|

| 否 | 是 |

当使用 | 否 |

|

| 否 | 否 |

|

是: |

|

| 否 | 否 | HAProxy 集的 Cookie 用于会话跟踪,用于将客户端连接映射到特定的后端服务器。允许设置这些标头可能会影响 HAProxy 的会话关联,并限制 HAProxy 的 Cookie 的所有权。 | 是:

|

2.3.9.13. 在 Ingress Controller 中设置或删除 HTTP 请求和响应标头

出于合规的原因,您可以设置或删除某些 HTTP 请求和响应标头。您可以为 Ingress Controller 提供的所有路由或特定路由设置或删除这些标头。

例如,您可能想要迁移集群中运行的应用程序以使用 mutual TLS,这需要您的应用程序检查 X-Forwarded-Client-Cert 请求标头,但 AWS 默认 Ingress Controller 上的 Red Hat OpenShift Service 提供了一个 X-SSL-Client-Der 请求标头。

以下流程修改 Ingress Controller 来设置 X-Forwarded-Client-Cert 请求标头,并删除 X-SSL-Client-Der 请求标头。

先决条件

-

已安装 OpenShift CLI(

oc)。 -

您可以使用具有

cluster-admin角色的用户访问 Red Hat OpenShift Service on AWS 集群。

流程

编辑 Ingress Controller 资源:

$ oc -n openshift-ingress-operator edit ingresscontroller/default将 X-SSL-Client-Der HTTP 请求标头替换为 X-Forwarded-Client-Cert HTTP 请求标头:

apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: httpHeaders: actions:1 request:2 - name: X-Forwarded-Client-Cert3 action: type: Set4 set: value: "%{+Q}[ssl_c_der,base64]"5 - name: X-SSL-Client-Der action: type: Delete注意对于 HTTP 响应设置动态标头值,允许示例 fetchers 是

res.hdr和ssl_c_der。对于 HTTP 请求设置动态标头值,允许示例获取器为req.hdr和ssl_c_der。请求和响应动态值都可以使用lower和base64转换器。- 保存文件以使改变生效。

2.3.9.14. 使用 X-Forwarded 标头

您可以将 HAProxy Ingress Controller 配置为指定如何处理 HTTP 标头的策略,其中包括 Forwarded 和 X-Forwarded-For。Ingress Operator 使用 HTTPHeaders 字段配置 Ingress Controller 的 ROUTER_SET_FORWARDED_HEADERS 环境变量。

流程

为 Ingress Controller 配置

HTTPHeaders字段。使用以下命令来编辑

IngressController资源:$ oc edit IngressController在

spec下,将HTTPHeaders策略字段设置为Append、Replace、IfNone或Never:apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: httpHeaders: forwardedHeaderPolicy: Append

使用案例示例

作为集群管理员,您可以:

配置将

X-Forwarded-For标头注入每个请求的外部代理,然后将其转发到 Ingress Controller。要将 Ingress Controller 配置为通过未修改的标头传递,您需要指定

never策略。然后,Ingress Controller 不会设置标头,应用程序只接收外部代理提供的标头。将 Ingress Controller 配置为通过未修改的外部代理在外部集群请求上设置

X-Forwarded-For标头。要将 Ingress Controller 配置为在不通过外部代理的内部集群请求上设置

X-Forwarded-For标头,请指定if-none策略。如果 HTTP 请求已经通过外部代理设置了标头,则 Ingress Controller 会保留它。如果缺少标头,因为请求没有通过代理,Ingress Controller 会添加标头。

作为应用程序开发人员,您可以:

配置特定于应用程序的外部代理来注入

X-Forwarded-For标头。要配置 Ingress Controller,以便在不影响其他路由策略的情况下将标头传递到应用程序的路由,请在应用程序的路由上添加注解

haproxy.router.openshift.io/set-forwarded-headers: if-none或haproxy.router.openshift.io/set-forwarded-headers: never。注意您可以根据每个路由设置

haproxy.router.openshift.io/set-forwarded-headers注解,独立于 Ingress Controller 的全局设置值。

2.3.9.15. 在 Ingress Controller 上启用或禁用 HTTP/2

您可以在 HAProxy 中启用或禁用透明端到端的 HTTP/2 连接。应用程序所有者可以使用 HTTP/2 协议功能,包括单一连接、标头压缩、二进制流等。

您可以为单个 Ingress Controller 或整个集群启用或禁用 HTTP/2 连接。

如果您为单个 Ingress Controller 和整个集群启用或禁用 HTTP/2 连接,Ingress Controller 的 HTTP/2 配置优先于集群的 HTTP/2 配置。

要在从客户端到 HAProxy 实例的连接中启用 HTTP/2,路由必须指定一个自定义证书。使用默认证书的路由无法使用 HTTP/2。这一限制是避免连接并发问题(如客户端为使用相同证书的不同路由重新使用连接)所必需的。

对每个路由类型进行 HTTP/2 连接,请考虑以下用例:

- 对于重新加密路由,如果应用程序支持使用应用程序级别协议协商(ALPN)来协商 HTTP/2,则从 HAProxy 到应用程序 pod 的连接可以使用 HTTP/2。您不能使用带有重新加密路由的 HTTP/2,除非 Ingress Controller 启用了 HTTP/2。

- 对于 passthrough 路由,如果应用程序支持使用 ALPN 与客户端协商 HTTP/2,则连接可以使用 HTTP/2。如果 Ingress Controller 启用或禁用 HTTP/2,您可以使用带有 passthrough 路由的 HTTP/2。

-

对于边缘终止的安全路由,如果服务仅指定了

appProtocol: kubernetes.io/h2c,则连接会使用 HTTP/2。如果 Ingress Controller 启用或禁用 HTTP/2,您可以使用带有边缘终止安全路由的 HTTP/2。 -

对于不安全的路由,如果服务仅指定了

appProtocol: kubernetes.io/h2c,则连接会使用 HTTP/2。如果 Ingress Controller 启用或禁用 HTTP/2,您可以使用带有不安全路由的 HTTP/2。

对于非 passthrough 路由,Ingress Controller 会独立于客户端的连接来协商它与应用程序的连接。这意味着客户端可能会连接到 Ingress Controller,并协商 HTTP/1.1。然后,Ingress Controller 可能会连接到应用程序,协商 HTTP/2,并使用 HTTP/2 连接将应用程序从客户端 HTTP/1.1 连接转发请求。

如果客户端随后试图将其连接从 HTTP/1.1 升级到 WebSocket 协议,则此事件序列会导致问题。请考虑,如果您有一个希望接受 WebSocket 连接的应用程序,应用程序尝试允许 HTTP/2 协议协商,客户端将无法尝试升级到 WebSocket 协议。

2.3.9.15.1. 启用 HTTP/2

您可以在特定 Ingress Controller 上启用 HTTP/2,也可以为整个集群启用 HTTP/2。

流程

要在特定 Ingress Controller 上启用 HTTP/2,请输入

oc annotate命令:$ oc -n openshift-ingress-operator annotate ingresscontrollers/<ingresscontroller_name> ingress.operator.openshift.io/default-enable-http2=true1 - 1

- 将

<ingresscontroller_name>替换为 Ingress Controller 的名称以启用 HTTP/2。

要为整个集群启用 HTTP/2,请输入

oc annotate命令:$ oc annotate ingresses.config/cluster ingress.operator.openshift.io/default-enable-http2=true

或者,您可以应用以下 YAML 代码来启用 HTTP/2:

apiVersion: config.openshift.io/v1

kind: Ingress

metadata:

name: cluster

annotations:

ingress.operator.openshift.io/default-enable-http2: "true"2.3.9.15.2. 禁用 HTTP/2

您可以在特定 Ingress Controller 上禁用 HTTP/2,也可以为整个集群禁用 HTTP/2。

流程

要在特定 Ingress Controller 上禁用 HTTP/2,请输入

oc annotate命令:$ oc -n openshift-ingress-operator annotate ingresscontrollers/<ingresscontroller_name> ingress.operator.openshift.io/default-enable-http2=false1 - 1

- 将

<ingresscontroller_name>替换为 Ingress Controller 的名称以禁用 HTTP/2。

要为整个集群禁用 HTTP/2,请输入

oc annotate命令:$ oc annotate ingresses.config/cluster ingress.operator.openshift.io/default-enable-http2=false

或者,您可以应用以下 YAML 代码来禁用 HTTP/2:

apiVersion: config.openshift.io/v1

kind: Ingress

metadata:

name: cluster

annotations:

ingress.operator.openshift.io/default-enable-http2: "false"2.3.9.16. 为 Ingress Controller 配置 PROXY 协议

当 Ingress Controller 使用 HostNetwork、NodePortService 或 Private 端点发布策略类型时,集群管理员可以配置 PROXY 协议。PROXY 协议使负载均衡器能够为 Ingress Controller 接收的连接保留原始客户端地址。原始客户端地址可用于记录、过滤和注入 HTTP 标头。在默认配置中,Ingress Controller 接收的连接只包含与负载均衡器关联的源地址。

使用 Keepalived Ingress Virtual IP (VIP) 在非云平台上带有安装程序置备的集群的默认 Ingress Controller 不支持 PROXY 协议。

PROXY 协议使负载均衡器能够为 Ingress Controller 接收的连接保留原始客户端地址。原始客户端地址可用于记录、过滤和注入 HTTP 标头。在默认配置中,Ingress Controller 接收的连接只包含与负载均衡器关联的源 IP 地址。

对于 passthrough 路由配置,Red Hat OpenShift Service on AWS 集群中的服务器无法观察原始客户端源 IP 地址。如果您需要知道原始客户端源 IP 地址,请为 Ingress Controller 配置 Ingress 访问日志记录,以便您可以查看客户端源 IP 地址。

对于重新加密和边缘路由,Red Hat OpenShift Service on AWS 路由器设置 Forwarded 和 X-Forwarded-For 标头,以便应用程序工作负载检查客户端源 IP 地址。

如需有关 Ingress 访问日志的更多信息,请参阅"配置 Ingress 访问日志"。

使用 LoadBalancerService 端点发布策略类型时不支持为 Ingress Controller 配置 PROXY 协议。这个限制是因为当 Red Hat OpenShift Service on AWS 在云平台中运行时,Ingress Controller 指定了应使用服务负载均衡器,Ingress Operator 会配置负载均衡器服务,并根据保留源地址的平台要求启用 PROXY 协议。

您必须将 Red Hat OpenShift Service on AWS 和外部负载均衡器配置为使用 PROXY 协议或 TCP。

云部署不支持此功能。这个限制是因为当 Red Hat OpenShift Service on AWS 在云平台中运行时,Ingress Controller 指定了应使用服务负载均衡器,Ingress Operator 会配置负载均衡器服务,并根据保留源地址的平台要求启用 PROXY 协议。

您必须将 Red Hat OpenShift Service on AWS 和外部负载均衡器配置为使用 PROXY 协议或使用传输控制协议(TCP)。

先决条件

- 已创建一个 Ingress Controller。

流程

在 CLI 中输入以下命令来编辑 Ingress Controller 资源:

$ oc -n openshift-ingress-operator edit ingresscontroller/default设置 PROXY 配置:

如果您的 Ingress Controller 使用

HostNetwork端点发布策略类型,请将spec.endpointPublishingStrategy.hostNetwork.protocol子字段设置为PROXY:hostNetwork配置为PROXY的示例# ... spec: endpointPublishingStrategy: hostNetwork: protocol: PROXY type: HostNetwork # ...如果您的 Ingress Controller 使用

NodePortService端点发布策略类型,请将spec.endpointPublishingStrategy.nodePort.protocol子字段设置为PROXY:nodePort配置为PROXY示例# ... spec: endpointPublishingStrategy: nodePort: protocol: PROXY type: NodePortService # ...如果您的 Ingress Controller 使用

Private端点发布策略类型,请将spec.endpointPublishingStrategy.private.protocol子字段设置为PROXY:到

PROXY的私有配置示例# ... spec: endpointPublishingStrategy: private: protocol: PROXY type: Private # ...

2.3.9.17. 使用 appsDomain 选项指定备选集群域

作为集群管理员,您可以通过配置 appsDomain 字段来为用户创建的路由指定默认集群域替代内容。appsDomain 字段是要使用的 Red Hat OpenShift Service on AWS 的可选域,而不是默认值,它在 domain 字段中指定。如果您指定了其它域,它会覆盖为新路由确定默认主机的目的。

例如,您可以将您公司的 DNS 域用作集群中运行的应用程序的路由和入口的默认域。

先决条件

- 您已在 AWS 集群上部署了 Red Hat OpenShift Service。

-

已安装

oc命令行界面。

流程

通过为用户创建的路由指定备选默认域来配置

appsDomain字段。编辑 ingress

集群资源 :$ oc edit ingresses.config/cluster -o yaml编辑 YAML 文件:

示例

appsDomain配置为test.example.comapiVersion: config.openshift.io/v1 kind: Ingress metadata: name: cluster spec: domain: apps.example.com1 appsDomain: <test.example.com>2

通过公开路由并验证路由域更改,验证现有路由是否包含

appsDomain字段中指定的域名:注意在公开路由前,等待

openshift-apiserver完成滚动更新。公开路由:

$ oc expose service hello-openshift输出示例

route.route.openshift.io/hello-openshift exposed运行以下命令来获取路由列表:

$ oc get routes输出示例

NAME HOST/PORT PATH SERVICES PORT TERMINATION WILDCARD hello-openshift hello_openshift-<my_project>.test.example.com hello-openshift 8080-tcp None

2.3.9.18. 转换 HTTP 标头的大小写

默认情况下,HAProxy HTTP 的标头名称是小写的,例如,会将 Host: xyz.com 更改为 host: xyz.com。如果旧应用程序对 HTTP 标头名称中使用大小写敏感,请使用 Ingress Controller spec.httpHeaders.headerNameCaseAdjustments API 字段进行调整来适应旧的应用程序,直到它们被改变。

Red Hat OpenShift Service on AWS 包括 HAProxy 2.8。如果要更新基于 web 的负载均衡器的这个版本,请确保将 spec.httpHeaders.headerNameCaseAdjustments 部分添加到集群的配置文件中。

作为集群管理员,您可以使用 oc patch 命令,或设置 Ingress Controller YAML 文件中的 HeaderNameCaseAdjustments 字段来转换 HTTP 标头的大小写。

先决条件

-

已安装 OpenShift CLI(

oc)。 -

您可以使用具有

cluster-admin角色的用户访问集群。

流程

使用

oc patch命令大写 HTTP 标头。运行以下命令,将 HTTP 标头从

host更改为Host:$ oc -n openshift-ingress-operator patch ingresscontrollers/default --type=merge --patch='{"spec":{"httpHeaders":{"headerNameCaseAdjustments":["Host"]}}}'创建

Route资源 YAML 文件,以便注解可应用到应用程序。名为

my-application的路由示例apiVersion: route.openshift.io/v1 kind: Route metadata: annotations: haproxy.router.openshift.io/h1-adjust-case: true1 name: <application_name> namespace: <application_name> # ...- 1

- 设置

haproxy.router.openshift.io/h1-adjust-case,以便 Ingress Controller 能够调整指定的host请求标头。

通过在 Ingress Controller YAML 配置文件中配置

HeaderNameCaseAdjustments字段指定调整。以下示例 Ingress Controller YAML 文件将 HTTP/1 请求的

host标头调整为Host,以适当地注解路由:Ingress Controller YAML 示例

apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: httpHeaders: headerNameCaseAdjustments: - Host以下示例路由中,使用

haproxy.router.openshift.io/h1-adjust-case注解启用对 HTTP 响应标头名称的大小写调整:路由 YAML 示例

apiVersion: route.openshift.io/v1 kind: Route metadata: annotations: haproxy.router.openshift.io/h1-adjust-case: true1 name: my-application namespace: my-application spec: to: kind: Service name: my-application- 1

- 将

haproxy.router.openshift.io/h1-adjust-case设置为 true。

2.3.9.19. 使用路由器压缩

您可以将 HAProxy Ingress Controller 配置为为特定 MIME 类型全局指定路由器压缩。您可以使用 mimeTypes 变量定义压缩应用到的 MIME 类型的格式。类型包括:application, image, message, multipart, text, video, 或带有一个 "X-" 前缀的自定义类型。要查看 MIME 类型和子类型的完整表示法,请参阅 RFC1341。

为压缩分配的内存可能会影响最大连接。此外,对大型缓冲区的压缩可能导致延迟,如非常复杂的正则表达式或较长的正则表达式列表。

并非所有 MIME 类型从压缩中受益,但 HAProxy 仍然使用资源在指示时尝试压缩。通常而言,文本格式(如 html、css 和 js)与压缩格式获益,但已经压缩的格式(如图像、音频和视频)可能会因为需要压缩操作而无法获得太多的好处。

流程

为 Ingress Controller 配置

httpCompression字段。使用以下命令来编辑

IngressController资源:$ oc edit -n openshift-ingress-operator ingresscontrollers/default在

spec下,将httpCompression策略字段设置为mimeTypes,并指定应该应用压缩的 MIME 类型列表:apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: httpCompression: mimeTypes: - "text/html" - "text/css; charset=utf-8" - "application/json" ...

2.3.9.20. 公开路由器指标

您可以在默认统计端口 1936 上以 Prometheus 格式公开 HAProxy 路由器指标。外部指标收集和聚合系统(如 Prometheus)可以访问 HAProxy 路由器指标。您可以在浏览器中以 HTML 的形式和以逗号分隔的值 (CSV) 格式查看 HAProxy 路由器指标。

先决条件

- 您已将防火墙配置为访问默认统计数据端口 1936。

流程

运行以下命令来获取路由器 pod 名称:

$ oc get pods -n openshift-ingress输出示例

NAME READY STATUS RESTARTS AGE router-default-76bfffb66c-46qwp 1/1 Running 0 11h获取路由器的用户名和密码,路由器 Pod 存储在

/var/lib/haproxy/conf/metrics-auth/statsUsername和/var/lib/haproxy/conf/metrics-auth/statsPassword文件中:运行以下命令来获取用户名:

$ oc rsh <router_pod_name> cat metrics-auth/statsUsername运行以下命令来获取密码:

$ oc rsh <router_pod_name> cat metrics-auth/statsPassword

运行以下命令,获取路由器 IP 和指标证书:

$ oc describe pod <router_pod>运行以下命令,以 Prometheus 格式获取原始统计信息:

$ curl -u <user>:<password> http://<router_IP>:<stats_port>/metrics运行以下命令来安全地访问指标:

$ curl -u user:password https://<router_IP>:<stats_port>/metrics -k运行以下命令,访问默认的 stats 端口 1936:

$ curl -u <user>:<password> http://<router_IP>:<stats_port>/metrics例 2.1. 输出示例

... # HELP haproxy_backend_connections_total Total number of connections. # TYPE haproxy_backend_connections_total gauge haproxy_backend_connections_total{backend="http",namespace="default",route="hello-route"} 0 haproxy_backend_connections_total{backend="http",namespace="default",route="hello-route-alt"} 0 haproxy_backend_connections_total{backend="http",namespace="default",route="hello-route01"} 0 ... # HELP haproxy_exporter_server_threshold Number of servers tracked and the current threshold value. # TYPE haproxy_exporter_server_threshold gauge haproxy_exporter_server_threshold{type="current"} 11 haproxy_exporter_server_threshold{type="limit"} 500 ... # HELP haproxy_frontend_bytes_in_total Current total of incoming bytes. # TYPE haproxy_frontend_bytes_in_total gauge haproxy_frontend_bytes_in_total{frontend="fe_no_sni"} 0 haproxy_frontend_bytes_in_total{frontend="fe_sni"} 0 haproxy_frontend_bytes_in_total{frontend="public"} 119070 ... # HELP haproxy_server_bytes_in_total Current total of incoming bytes. # TYPE haproxy_server_bytes_in_total gauge haproxy_server_bytes_in_total{namespace="",pod="",route="",server="fe_no_sni",service=""} 0 haproxy_server_bytes_in_total{namespace="",pod="",route="",server="fe_sni",service=""} 0 haproxy_server_bytes_in_total{namespace="default",pod="docker-registry-5-nk5fz",route="docker-registry",server="10.130.0.89:5000",service="docker-registry"} 0 haproxy_server_bytes_in_total{namespace="default",pod="hello-rc-vkjqx",route="hello-route",server="10.130.0.90:8080",service="hello-svc-1"} 0 ...通过在浏览器中输入以下 URL 来启动 stats 窗口:

http://<user>:<password>@<router_IP>:<stats_port>可选:通过在浏览器中输入以下 URL 来获取 CSV 格式的统计信息:

http://<user>:<password>@<router_ip>:1936/metrics;csv

2.3.9.21. 自定义 HAProxy 错误代码响应页面

作为集群管理员,您可以为 503、404 或两个错误页面指定自定义错误代码响应页面。当应用 Pod 没有运行时,HAProxy 路由器会提供一个 503 错误页面,如果请求的 URL 不存在,则 HAProxy 路由器会提供 404 错误页面。例如,如果您自定义 503 错误代码响应页面,则应用 Pod 未运行时会提供页面,并且 HAProxy 路由器为不正确的路由或不存在的路由提供默认的 404 错误代码 HTTP 响应页面。

自定义错误代码响应页面在配置映射中指定,然后修补至 Ingress Controller。配置映射键有两个可用的文件名,如下所示:error-page-503.http 和 error-page-404.http。

自定义 HTTP 错误代码响应页面必须遵循 HAProxy HTTP 错误页面配置指南。以下是 AWS HAProxy 路由器 http 503 错误代码响应页面 的默认 Red Hat OpenShift Service 的示例。您可以使用默认内容作为模板来创建自己的自定义页面。

默认情况下,当应用没有运行或者路由不正确或不存在时,HAProxy 路由器仅提供一个 503 错误页面。这个默认行为与 Red Hat OpenShift Service on AWS 4.8 及更早版本的行为相同。如果没有提供用于自定义 HTTP 错误代码响应的配置映射,且您使用的是自定义 HTTP 错误代码响应页面,路由器会提供默认的 404 或 503 错误代码响应页面。

如果您使用 Red Hat OpenShift Service on AWS 默认 503 错误代码页面作为自定义的模板,文件中的标头需要一个编辑器来使用 CRLF 行结尾。

流程

在

openshift-config命名空间中创建一个名为my-custom-error-code-pages的配置映射:$ oc -n openshift-config create configmap my-custom-error-code-pages \ --from-file=error-page-503.http \ --from-file=error-page-404.http重要如果没有为自定义错误代码响应页面指定正确的格式,则会出现路由器 pod 中断。要解决此中断,您必须删除或更正配置映射并删除受影响的路由器 pod,以便使用正确的信息重新创建它们。

对 Ingress Controller 进行补丁以根据名称引用

my-custom-error-code-pages配置映射:$ oc patch -n openshift-ingress-operator ingresscontroller/default --patch '{"spec":{"httpErrorCodePages":{"name":"my-custom-error-code-pages"}}}' --type=mergeIngress Operator 将

my-custom-error-code-pages配置映射从openshift-config命名空间复制到openshift-ingress命名空间。Operator 根据openshift-ingress命名空间中的模式<your_ingresscontroller_name>-errorpages命名配置映射。显示副本:

$ oc get cm default-errorpages -n openshift-ingress输出示例

NAME DATA AGE default-errorpages 2 25s1 - 1

- 配置映射名称示例为

default-errorpages,因为defaultIngress Controller 自定义资源 (CR) 已被修补。

确认包含自定义错误响应页面的配置映射挂载到路由器卷中,其中配置映射键是具有自定义 HTTP 错误代码响应的文件名:

对于 503 自定义 HTTP 自定义错误代码响应:

$ oc -n openshift-ingress rsh <router_pod> cat /var/lib/haproxy/conf/error_code_pages/error-page-503.http对于 404 自定义 HTTP 自定义错误代码响应:

$ oc -n openshift-ingress rsh <router_pod> cat /var/lib/haproxy/conf/error_code_pages/error-page-404.http

验证

验证自定义错误代码 HTTP 响应:

创建测试项目和应用程序:

$ oc new-project test-ingress$ oc new-app django-psql-example对于 503 自定义 http 错误代码响应:

- 停止应用的所有容器集。

运行以下 curl 命令或在浏览器中访问路由主机名:

$ curl -vk <route_hostname>

对于 404 自定义 http 错误代码响应:

- 访问不存在的路由或路由不正确。

运行以下 curl 命令或在浏览器中访问路由主机名:

$ curl -vk <route_hostname>

检查

haproxy.config文件中的errorfile属性是否正确:$ oc -n openshift-ingress rsh <router> cat /var/lib/haproxy/conf/haproxy.config | grep errorfile

2.3.9.22. 设置 Ingress Controller 最大连接数

集群管理员可以设置 OpenShift 路由器部署的最大同时连接数。您可以修补现有的 Ingress Controller 来提高最大连接数。

先决条件

- 以下假设您已创建了 Ingress Controller

流程

更新 Ingress Controller,以更改 HAProxy 的最大连接数:

$ oc -n openshift-ingress-operator patch ingresscontroller/default --type=merge -p '{"spec":{"tuningOptions": {"maxConnections": 7500}}}'警告如果您设置了大于当前操作系统的

spec.tuningOptions.maxConnections值,则 HAProxy 进程不会启动。有关这个参数的更多信息,请参阅"Ingress Controller 配置参数"部分中的表。

下表详细介绍了 Ingress Operator 的组件,以及红帽站点可靠性工程师 (SRE) 是否维护 Red Hat OpenShift Service on AWS 中的这个组件。

| Ingress 组件 | 管理方 | 默认配置? |

|---|---|---|

| Scaling Ingress Controller | SRE | 是 |

| Ingress Operator thread count | SRE | 是 |

| Ingress Controller 访问日志 | SRE | 是 |

| Ingress Controller 分片 | SRE | 是 |

| Ingress Controller 路由准入策略 | SRE | 是 |

| Ingress Controller 通配符路由 | SRE | 是 |

| Ingress Controller X-Forwarded 标头 | SRE | 是 |

| Ingress Controller 路由压缩 | SRE | 是 |

Ingress Node Firewall Operator 提供了一个无状态的、基于 eBPF 的防火墙,用于管理 Red Hat OpenShift Service on AWS 中的节点级别的入口流量。

2.4.1. Ingress Node Firewall Operator

Ingress Node Firewall Operator 通过将守护进程集部署到您在防火墙配置中指定和管理的节点,在节点级别提供入口防火墙规则。要部署守护进程集,请创建一个 IngressNodeFirewallConfig 自定义资源 (CR)。Operator 应用 IngressNodeFirewallConfig CR 来创建入口节点防火墙守护进程集 daemon,它在与 nodeSelector 匹配的所有节点上运行。

您可以配置 IngressNodeFirewall CR 的规则,并使用 nodeSelector 将值设置为 "true" 的集群。

Ingress Node Firewall Operator 仅支持无状态防火墙规则。

不支持原生 XDP 驱动程序的网络接口控制器 (NIC) 将以较低性能运行。

对于 Red Hat OpenShift Service on AWS 4.14 或更高版本,您必须在 RHEL 9.0 或更高版本上运行 Ingress Node Firewall Operator。

2.4.2. 安装 Ingress Node Firewall Operator

作为集群管理员,您可以使用 Red Hat OpenShift Service on AWS CLI 或 Web 控制台安装 Ingress Node Firewall Operator。

2.4.2.1. 使用 CLI 安装 Ingress Node Firewall Operator

作为集群管理员,您可以使用 CLI 安装 Operator。

先决条件

-

已安装 OpenShift CLI(

oc)。 - 有管理员特权的帐户。

流程

运行以下命令来创建

openshift-ingress-node-firewall命名空间:$ cat << EOF| oc create -f - apiVersion: v1 kind: Namespace metadata: labels: pod-security.kubernetes.io/enforce: privileged pod-security.kubernetes.io/enforce-version: v1.24 name: openshift-ingress-node-firewall EOF运行以下命令来创建

OperatorGroupCR:$ cat << EOF| oc create -f - apiVersion: operators.coreos.com/v1 kind: OperatorGroup metadata: name: ingress-node-firewall-operators namespace: openshift-ingress-node-firewall EOF订阅 Ingress Node Firewall Operator。

要为 Ingress Node Firewall Operator 创建

SubscriptionCR,请输入以下命令:$ cat << EOF| oc create -f - apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: ingress-node-firewall-sub namespace: openshift-ingress-node-firewall spec: name: ingress-node-firewall channel: stable source: redhat-operators sourceNamespace: openshift-marketplace EOF

要验证是否已安装 Operator,请输入以下命令:

$ oc get ip -n openshift-ingress-node-firewall输出示例

NAME CSV APPROVAL APPROVED install-5cvnz ingress-node-firewall.4.0-202211122336 Automatic true要验证 Operator 的版本,请输入以下命令:

$ oc get csv -n openshift-ingress-node-firewall输出示例

NAME DISPLAY VERSION REPLACES PHASE ingress-node-firewall.4.0-202211122336 Ingress Node Firewall Operator 4.0-202211122336 ingress-node-firewall.4.0-202211102047 Succeeded

2.4.2.2. 使用 Web 控制台安装 Ingress Node Firewall Operator

作为集群管理员,您可以使用 Web 控制台安装 Operator。

先决条件

-

已安装 OpenShift CLI(

oc)。 - 有管理员特权的帐户。

流程

安装 Ingress Node Firewall Operator:

- 在 Red Hat OpenShift Service on AWS web 控制台中,点 Operators → OperatorHub。

- 从可用的 Operator 列表中选择 Ingress Node Firewall Operator,然后点 Install。

- 在 Install Operator 页面中,在 Installed Namespace 下选择 Operator recommended Namespace。

- 点 Install。

验证 Ingress Node Firewall Operator 是否已成功安装:

- 导航到 Operators → Installed Operators 页面。

确保 openshift-ingress-node-firewall 项目中列出的 Ingress Node Firewall Operator 的 Status 为 InstallSucceeded。

注意在安装过程中,Operator 可能会显示 Failed 状态。如果安装过程结束后有 InstallSucceeded 信息,您可以忽略这个 Failed 信息。

如果 Operator 没有 InstallSucceeded 状态,请按照以下步骤进行故障排除:

- 检查 Operator Subscriptions 和 Install Plans 选项卡中的 Status 项中是否有任何错误。

-

进入到 Workloads → Pods 页面,在

openshift-ingress-node-firewall项目中检查 pod 的日志。 检查 YAML 文件的命名空间。如果缺少注解,您可以使用以下命令将注解

workload.openshift.io/allowed=management添加到 Operator 命名空间中:$ oc annotate ns/openshift-ingress-node-firewall workload.openshift.io/allowed=management注意对于单节点 OpenShift 集群,

openshift-ingress-node-firewall命名空间需要workload.openshift.io/allowed=management注解。

2.4.3. 部署 Ingress Node Firewall Operator

前提条件

- 已安装 Ingress Node Firewall Operator。

流程

要拒绝 Ingress Node Firewall Operator,请创建一个 IngressNodeFirewallConfig 自定义资源,该资源将部署 Operator 的守护进程集。您可以通过应用防火墙规则,将一个或多个 IngressNodeFirewall CRD 部署到节点。

-

在

openshift-ingress-node-firewall命名空间中创建IngressNodeFirewallConfig,名为ingressnodefirewallconfig。 运行以下命令来部署 Ingress Node Firewall Operator 规则:

$ oc apply -f rule.yaml

2.4.3.1. Ingress 节点防火墙配置对象

下表中描述了 Ingress Node Firewall 配置对象的字段:

| 字段 | 类型 | 描述 |

|---|---|---|

|

|

|

CR 对象的名称。防火墙规则对象的名称必须是 |

|

|

|

Ingress Firewall Operator CR 对象的命名空间。 |

|

|

| 通过指定节点标签 (label) 用于目标节点的节点选择约束。例如: 注意

|

|

|

| 指定 Node Ingress Firewall Operator 使用 eBPF Manager Operator 还是不管理 eBPF 程序。这个功能是一个技术预览功能。 有关红帽技术预览功能支持范围的更多信息,请参阅技术预览功能支持范围。 |

Operator 使用 CR,并在与 nodeSelector 匹配的所有节点上创建一个入口节点防火墙守护进程集。

Ingress Node Firewall Operator 示例配置

以下示例中指定了完整的 Ingress Node 防火墙配置:

Ingress 节点防火墙配置对象示例

apiVersion: ingressnodefirewall.openshift.io/v1alpha1

kind: IngressNodeFirewallConfig

metadata:

name: ingressnodefirewallconfig

namespace: openshift-ingress-node-firewall

spec:

nodeSelector:

node-role.kubernetes.io/worker: ""

Operator 使用 CR,并在与 nodeSelector 匹配的所有节点上创建一个入口节点防火墙守护进程集。

2.4.3.2. Ingress 节点防火墙规则对象

下表中描述了 Ingress Node Firewall 规则对象的字段:

| 字段 | 类型 | 描述 |

|---|---|---|

|

|

| CR 对象的名称。 |

|

|

|

此对象的字段指定要应用防火墙规则的接口。例如, |

|

|

|

您可以使用 |

|

|

|

|

2.4.3.2.1. Ingress 对象配置

ingress 对象的值在下表中定义:

| 字段 | 类型 | 描述 |

|---|---|---|

|

|

| 允许您设置 CIDR 块。您可以从不同地址系列配置多个 CIDR。 注意

不同的 CIDR 允许您使用相同的顺序规则。如果同一节点有多个 |

|

|

|

对于每个

将 注意 Ingress 防火墙规则使用阻止任何无效配置的验证 Webhook 进行验证。验证 Webhook 会阻止阻塞任何关键集群服务,如 API 服务器。 |

2.4.3.2.2. Ingress 节点防火墙规则对象示例

以下示例中指定了完整的 Ingress Node 防火墙配置:

Ingress 节点防火墙配置示例

apiVersion: ingressnodefirewall.openshift.io/v1alpha1

kind: IngressNodeFirewall

metadata:

name: ingressnodefirewall

spec:

interfaces:

- eth0

nodeSelector:

matchLabels:

<ingress_firewall_label_name>: <label_value>

ingress:

- sourceCIDRs:

- 172.16.0.0/12

rules:

- order: 10

protocolConfig:

protocol: ICMP

icmp:

icmpType: 8 #ICMP Echo request

action: Deny

- order: 20

protocolConfig:

protocol: TCP

tcp:

ports: "8000-9000"

action: Deny

- sourceCIDRs:

- fc00:f853:ccd:e793::0/64

rules:

- order: 10

protocolConfig:

protocol: ICMPv6

icmpv6:

icmpType: 128 #ICMPV6 Echo request

action: Deny- 1

- 节点上必须存在 <label_name> 和 <label_value>,且必须与应用到您希望

ingressfirewallconfigCR 运行的节点的nodeselector标签和值匹配。<label_value> 可以是true或false。通过使用nodeSelector标签,您可以针对单独的节点组为目标,以使用ingressfirewallconfigCR 应用不同的规则。

2.4.3.2.3. 零信任 Ingress Node Firewall 规则对象示例

零信任 Ingress 节点防火墙规则可为多接口集群提供额外的安全性。例如,您可以使用零信任 Ingress Node Firewall 规则来丢弃除 SSH 之外的特定接口上的网络流量。

以下示例中指定了零信任 Ingress Node Firewall 规则集的完整配置:

用户需要为其提供应用程序使用的所有端口添加到允许列表,以确保正常工作。

零信任 Ingress 节点防火墙规则示例

apiVersion: ingressnodefirewall.openshift.io/v1alpha1

kind: IngressNodeFirewall

metadata:

name: ingressnodefirewall-zero-trust

spec:

interfaces:

- eth1

nodeSelector:

matchLabels:

<ingress_firewall_label_name>: <label_value>

ingress:

- sourceCIDRs:

- 0.0.0.0/0

rules:

- order: 10

protocolConfig:

protocol: TCP

tcp:

ports: 22

action: Allow

- order: 20

action: Deny eBPF Manager Operator 集成只是一个技术预览功能。技术预览功能不受红帽产品服务等级协议(SLA)支持,且功能可能并不完整。红帽不推荐在生产环境中使用它们。这些技术预览功能可以使用户提早试用新的功能,并有机会在开发阶段提供反馈意见。

有关红帽技术预览功能支持范围的更多信息,请参阅技术预览功能支持范围。

2.4.4. Ingress Node Firewall Operator 集成

Ingress 节点防火墙使用 eBPF 程序来实现其一些关键的防火墙功能。默认情况下,这些 eBPF 程序使用特定于 Ingress 节点防火墙的机制加载到内核中。您可以将 Ingress Node Firewall Operator 配置为使用 eBPF Manager Operator 来加载和管理这些程序。

当启用此集成时,会有以下限制:

- 如果 XDP 不可用,Ingress Node Firewall Operator 使用 TCX,而 TCX 与 bpfman 不兼容。

-

Ingress Node Firewall Operator 守护进程集 pod 会保持在

ContainerCreating状态,直到应用防火墙规则为止。 - Ingress Node Firewall Operator 守护进程设置 pod 以特权运行。

Ingress 节点防火墙使用 eBPF 程序来实现其一些关键的防火墙功能。默认情况下,这些 eBPF 程序使用特定于 Ingress 节点防火墙的机制加载到内核中。

作为集群管理员,您可以将 Ingress Node Firewall Operator 配置为使用 eBPF Manager Operator 来加载和管理这些程序,这会添加额外的安全性和可观察性功能。

前提条件

-

已安装 OpenShift CLI(

oc)。 - 有管理员特权的帐户。

- 已安装 Ingress Node Firewall Operator。

- 已安装 eBPF Manager Operator。

流程

将以下标签应用到

ingress-node-firewall-system命名空间:$ oc label namespace openshift-ingress-node-firewall \ pod-security.kubernetes.io/enforce=privileged \ pod-security.kubernetes.io/warn=privileged --overwrite编辑名为

ingressnodefirewallconfig的IngressNodeFirewallConfig对象并设置ebpfProgramManagerMode字段:Ingress Node Firewall Operator 配置对象

apiVersion: ingressnodefirewall.openshift.io/v1alpha1 kind: IngressNodeFirewallConfig metadata: name: ingressnodefirewallconfig namespace: openshift-ingress-node-firewall spec: nodeSelector: node-role.kubernetes.io/worker: "" ebpfProgramManagerMode: <ebpf_mode>其中:

<ebpf_mode> : 指定 Ingress Node Firewall Operator 是否使用 eBPF Manager Operator 来管理 eBPF 程序。必须为true或false。如果未设置,则不会使用 eBPF Manager。

2.4.6. 查看 Ingress Node Firewall Operator 规则

流程

运行以下命令来查看所有当前规则:

$ oc get ingressnodefirewall选择返回的

<resource>名称之一,并运行以下命令来查看规则或配置:$ oc get <resource> <name> -o yaml

2.4.7. 对 Ingress Node Firewall Operator 进行故障排除

运行以下命令列出已安装的 Ingress Node Firewall 自定义资源定义 (CRD):

$ oc get crds | grep ingressnodefirewall输出示例

NAME READY UP-TO-DATE AVAILABLE AGE ingressnodefirewallconfigs.ingressnodefirewall.openshift.io 2022-08-25T10:03:01Z ingressnodefirewallnodestates.ingressnodefirewall.openshift.io 2022-08-25T10:03:00Z ingressnodefirewalls.ingressnodefirewall.openshift.io 2022-08-25T10:03:00Z运行以下命令,以查看 Ingress Node Firewall Operator 的状态:

$ oc get pods -n openshift-ingress-node-firewall输出示例

NAME READY STATUS RESTARTS AGE ingress-node-firewall-controller-manager 2/2 Running 0 5d21h ingress-node-firewall-daemon-pqx56 3/3 Running 0 5d21h以下字段提供有关 Operator 状态的信息:

READY、STATUS、AGE、和RESTARTS。当 Ingress Node Firewall Operator 将守护进程集部署到分配的节点时,STATUS字段为Running。运行以下命令来收集所有入口防火墙节点 pod 的日志:

$ oc adm must-gather – gather_ingress_node_firewall在 sos 节点的报告中,其中包含位于

/sos_commands/ebpf的 eBPFbpftool输出的报告。这些报告包括用于或作为入口防火墙 XDP 处理数据包处理、更新统计信息和发出事件的查找表。

第 3 章 ROSA 集群的网络验证

当您将 Red Hat OpenShift Service on AWS (ROSA)集群部署到现有的 Virtual Private Cloud (VPC)或创建带有集群新子网的额外机器池时,网络验证检查会自动运行。检查会验证您的网络配置并突出显示错误,允许您在部署前解决配置问题。

您还可以手动运行网络验证检查以验证现有集群的配置。

3.1. 了解 ROSA 集群的网络验证

当您将 Red Hat OpenShift Service on AWS (ROSA)集群部署到现有的 Virtual Private Cloud (VPC)或创建带有集群新子网的额外机器池时,会自动运行网络验证。这有助于您在部署前识别并解决配置问题。

当使用 Red Hat OpenShift Cluster Manager 准备安装集群时,会在 Virtual Private Cloud (VPC)子网设置页面中将子网输入到子网 ID 字段中运行自动检查。如果您使用带有互动模式的 ROSA CLI (rosa)创建集群,则检查会在提供所需的 VPC 网络信息后运行。如果您在没有互动模式的情况下使用 CLI,则检查会在集群创建前立即开始。

当您添加带有集群新子网的机器池时,自动网络验证会检查子网,以确保在置备机器池前可以使用网络连接。

自动网络验证完成后,会将记录发送到服务日志。记录提供验证检查的结果,包括任何网络配置错误。您可以在部署前解决发现的问题,并且部署具有更大的成功机会。

您还可以为现有集群手动运行网络验证。这可让您在配置更改后验证集群的网络配置。有关手动运行网络验证检查的步骤,请参阅 手动运行网络验证。

3.2. 网络验证检查的范围

网络验证包括以下每个要求:

- 父虚拟私有云(VPC)存在。

- 所有指定子网都属于 VPC。

-

VPC 已启用

enableDnsSupport。 -

VPC 已启用

enableDnsHostnames。 - egress 可用于 AWS 防火墙先决条件 部分中指定的所需域和端口组合。

3.3. 绕过自动网络验证

如果要将已知网络配置问题部署到 AWS (ROSA)集群上,可以绕过自动网络验证。

如果您在创建集群时绕过网络验证,集群具有有限的支持状态。安装后,您可以解决这个问题,然后手动运行网络验证。验证成功后会删除有限的支持状态。

使用 OpenShift Cluster Manager 绕过自动网络验证

当使用 Red Hat OpenShift Cluster Manager 将集群安装到现有的 VPC 时,您可以通过在 Virtual Private Cloud (VPC)子网设置页面中 选择 Bypass network 验证 来绕过自动验证。

3.4. 手动运行网络验证

在 AWS (ROSA)集群上安装 Red Hat OpenShift Service 后,您可以使用 Red Hat OpenShift Cluster Manager 或 ROSA CLI (rosa)手动运行网络验证检查。

使用 OpenShift Cluster Manager 手动运行网络验证

您可以使用 Red Hat OpenShift Cluster Manager 手动运行网络验证检查 AWS (ROSA)集群上的现有 Red Hat OpenShift Service。

前提条件

- 您有一个现有的 ROSA 集群。

- 您是集群所有者,或具有集群编辑器角色。

流程

- 进入到 OpenShift Cluster Manager 并选择您的集群。

- 从 Actions 下拉菜单中选择 Verify networking。

使用 CLI 手动运行网络验证

您可以使用 ROSA CLI (rosa)手动运行现有 Red Hat OpenShift Service on AWS (ROSA)集群的网络验证检查。

运行网络验证时,您可以指定一组 VPC 子网 ID 或集群名称。

前提条件

-

您已在安装主机上安装并配置了最新的 ROSA CLI (

rosa)。 - 您有一个现有的 ROSA 集群。

- 您是集群所有者,或具有集群编辑器角色。

流程

使用以下方法之一验证网络配置:

通过指定集群名称来验证网络配置。子网 ID 会自动检测到:

$ rosa verify network --cluster <cluster_name>1 - 1

- 将

<cluster_name>替换为集群的名称。

输出示例

I: Verifying the following subnet IDs are configured correctly: [subnet-03146b9b52b6024cb subnet-03146b9b52b2034cc] I: subnet-03146b9b52b6024cb: pending I: subnet-03146b9b52b2034cc: passed I: Run the following command to wait for verification to all subnets to complete: rosa verify network --watch --status-only --region us-east-1 --subnet-ids subnet-03146b9b52b6024cb,subnet-03146b9b52b2034cc确保所有子网的验证已完成:

$ rosa verify network --watch \1 --status-only \2 --region <region_name> \3 --subnet-ids subnet-03146b9b52b6024cb,subnet-03146b9b52b2034cc4 输出示例

I: Checking the status of the following subnet IDs: [subnet-03146b9b52b6024cb subnet-03146b9b52b2034cc] I: subnet-03146b9b52b6024cb: passed I: subnet-03146b9b52b2034cc: passed提示要输出完整的验证测试列表,您可以在运行

rosa verify network命令时包含--debug参数。

通过指定 VPC 子网 ID 来验证网络配置。将

<region_name> 替换为您的 AWS 区域,将<AWS_account_ID> 替换为您的 AWS 帐户 ID:$ rosa verify network --subnet-ids 03146b9b52b6024cb,subnet-03146b9b52b2034cc --region <region_name> --role-arn arn:aws:iam::<AWS_account_ID>:role/my-Installer-Role输出示例

I: Verifying the following subnet IDs are configured correctly: [subnet-03146b9b52b6024cb subnet-03146b9b52b2034cc] I: subnet-03146b9b52b6024cb: pending I: subnet-03146b9b52b2034cc: passed I: Run the following command to wait for verification to all subnets to complete: rosa verify network --watch --status-only --region us-east-1 --subnet-ids subnet-03146b9b52b6024cb,subnet-03146b9b52b2034cc确保所有子网的验证已完成:

$ rosa verify network --watch --status-only --region us-east-1 --subnet-ids subnet-03146b9b52b6024cb,subnet-03146b9b52b2034cc输出示例

I: Checking the status of the following subnet IDs: [subnet-03146b9b52b6024cb subnet-03146b9b52b2034cc] I: subnet-03146b9b52b6024cb: passed I: subnet-03146b9b52b2034cc: passed

第 4 章 配置集群范围代理

如果您使用现有的 Virtual Private Cloud (VPC),您可以在 Red Hat OpenShift Service on AWS (ROSA)集群安装过程中或安装集群后配置集群范围的代理。当您启用代理时,核心集群组件会被拒绝访问互联网,但代理不会影响用户工作负载。

只有集群系统出口流量会被代理,包括对云供应商 API 的调用。

如果使用集群范围代理,您需要维护到集群的代理可用性。如果代理不可用,这可能会影响集群的健康和支持性。

4.1. 配置集群范围代理的先决条件

要配置集群范围的代理,您必须满足以下要求。当您在安装过程中或安装后配置代理时,这些要求有效。

常规要求

- 您是集群所有者。

- 您的帐户有足够的权限。

- 集群有一个现有的 Virtual Private Cloud (VPC)。

- 代理可以访问集群的 VPC 和 VPC 的专用子网。此代理也可以从 VPC 的集群以及 VPC 的专用子网访问。

您已在 VPC 端点中添加了以下端点:

-

ec2.<aws_region>.amazonaws.com -

elasticloadbalancing.<aws_region>.amazonaws.com s3.<aws_region>.amazonaws.com需要这些端点才能完成节点到 AWS EC2 API 的请求。由于代理在容器级别而不是在节点级别工作,因此您必须通过 AWS 专用网络将这些请求路由到 AWS EC2 API。在代理服务器中的允许列表中添加 EC2 API 的公共 IP 地址是不够的。

重要在使用集群范围代理时,您必须将

s3.<aws_region>.amazonaws.com端点配置为类型Gateway。

-

网络要求

如果您的代理重新加密出口流量,则必须对域和端口组合创建排除。下表提供了这些例外的指导。

您的代理必须排除以下 OpenShift URL 的重新加密:

Expand 地址 协议/端口 功能 observatorium-mst.api.openshift.comhttps/443

必需。用于管理的 OpenShift 特定遥测。

sso.redhat.comhttps/443

https://cloud.redhat.com/openshift 站点使用 sso.redhat.com 中的身份验证来下载集群 pull secret,并使用 Red Hat SaaS 解决方案来简化订阅、集群清单和计费报告的监控。

4.2. 其他信任捆绑包的职责

如果您提供额外的信任捆绑包,您需要进行以下要求:

- 确保其他信任捆绑包的内容有效

- 确保证书(包括中间证书)包含在额外的信任捆绑包中,且未过期

- 跟踪到期,并为附加信任捆绑包中包含的证书执行必要的续订

- 使用更新的额外信任捆绑包更新集群配置

4.3. 在安装过程中配置代理

当您在 AWS (ROSA) 集群中安装 Red Hat OpenShift Service (ROSA) 集群时,可以配置 HTTP 或 HTTPS 代理到现有的 Virtual Private Cloud (VPC)集群中。您可以使用 Red Hat OpenShift Cluster Manager 或 ROSA CLI (rosa) 在安装过程中配置代理。

4.3.1. 使用 OpenShift Cluster Manager 在安装过程中配置代理

如果要在 AWS (ROSA) 集群上安装 Red Hat OpenShift Service,您可以在安装过程中使用 Red Hat OpenShift Cluster Manager 启用集群范围的 HTTP 或 HTTPS 代理。

在安装前,您必须验证可以从 VPC 访问代理,该代理是否可从安装到的 VPC 中。该代理还必须从 VPC 的专用子网访问。

有关使用 OpenShift Cluster Manager 在安装过程中配置集群范围代理的详细步骤,请参阅使用 OpenShift Cluster Manager 使用自定义创建集群。

4.3.2. 使用 CLI 在安装过程中配置代理

如果要在 AWS (ROSA) 集群中安装 Red Hat OpenShift Service (ROSA) 到现有的 Virtual Private Cloud (VPC),您可以使用 ROSA CLI (rosa) 在安装过程中启用集群范围的 HTTP 或 HTTPS 代理。

以下流程提供有关在安装过程中配置集群范围代理的 ROSA CLI (rosa) 参数的详细信息。有关使用 ROSA CLI 的常规安装步骤,请参阅使用 CLI 创建自定义集群。

先决条件

- 您已确认代理可以从安装集群的 VPC 访问。该代理还必须从 VPC 的专用子网访问。

流程

指定创建集群时的代理配置:

$ rosa create cluster \ <other_arguments_here> \ --additional-trust-bundle-file <path_to_ca_bundle_file> \1 2 3 --http-proxy http://<username>:<password>@<ip>:<port> \4 5 --https-proxy https://<username>:<password>@<ip>:<port> \6 7 --no-proxy example.com8 - 1 4 6

additional-trust-bundle-file、http-proxy和https-proxy参数都是可选。- 2

additional-trust-bundle-file参数是一个指向 PEM 编码 X.509 证书的捆绑包的文件路径,这些证书全部连接在一起。使用 TLS-inspecting 代理的用户需要 additional-trust-bundle-file 参数,除非代理的身份证书由 Red Hat Enterprise Linux CoreOS (RHCOS)信任捆绑包的颁发机构签名。无论代理是透明还是需要使用 http-proxy 和 https-proxy 参数明确配置,都适用。- 3 5 7

http-proxy和https-proxy参数必须指向有效的 URL。- 8

- 要排除代理的目标域名、IP 地址或网络 CIDR 的逗号分隔列表。

在域前面加上

.以仅匹配子域。例如:.y.com匹配x.y.com,但不匹配y.com。使用*可对所有目的地绕过所有代理。如果您扩展了未包含在安装配置中networking.machineNetwork[].cidr字段定义的 worker,您必须将它们添加到此列表中,以防止连接问题。如果未设置

httpProxy或httpsProxy字段,则此字段将被忽略。

4.4. 安装后配置代理

当您在 AWS (ROSA) 集群中安装 Red Hat OpenShift Service (ROSA) 集群后,可以配置 HTTP 或 HTTPS 代理到现有的 Virtual Private Cloud (VPC) 集群中。您可以使用 Red Hat OpenShift Cluster Manager 或 ROSA CLI (rosa) 在安装后配置代理。

4.4.1. 使用 OpenShift Cluster Manager 在安装后配置代理

您可以使用 Red Hat OpenShift Cluster Manager 将集群范围代理配置添加到 Virtual Private Cloud (VPC) 上的 AWS 集群中的现有 Red Hat OpenShift Service 中。

您还可以使用 OpenShift Cluster Manager 更新现有的集群范围代理配置。例如,如果代理的任何证书颁发机构过期,您可能需要更新代理的网络地址,或者替换额外的信任捆绑包。

集群将代理配置应用到 control plane 和计算节点。在应用配置时,每个集群节点暂时处于不可调度状态,并排空其工作负载。每个节点都会作为进程的一部分重启。

前提条件

- 在 AWS 集群上有一个 Red Hat OpenShift Service。

- 您的集群部署在 VPC 中。

流程

- 进入到 OpenShift Cluster Manager 并选择您的集群。

- 在 Networking 页面上的 Virtual Private Cloud (VPC) 部分下,点 Edit cluster-wide proxy。

在 Edit cluster-wide proxy 页面中,提供代理配置详情:

至少在以下字段之一中输入值:

- 指定有效的 HTTP 代理 URL。

- 指定有效的 HTTPS 代理 URL。

-

在 Additional trust bundle 字段中,提供 PEM 编码 X.509 证书捆绑包。如果您要替换现有的信任捆绑包文件,请选择 replace file 来查看字段。捆绑包添加到集群节点的可信证书存储中。如果您使用 TLS-inspecting 代理,则需要额外的信任捆绑包文件,除非代理的身份证书由 Red Hat Enterprise Linux CoreOS (RHCOS)信任捆绑包的颁发机构签名。无论代理是透明还是需要使用

http-proxy和https-proxy参数显式配置,这个要求都适用。

- 单击 Confirm。

验证

- 在 Networking 页面上的 Virtual Private Cloud (VPC) 部分下,验证集群的代理配置是否如预期。

4.4.2. 使用 CLI 在安装后配置代理

您可以使用 AWS (ROSA) CLI (rosa) 上的 Red Hat OpenShift Service 将集群范围的代理配置添加到 Virtual Private Cloud (VPC) 的现有 ROSA 集群中。

您还可以使用 rosa 更新现有的集群范围代理配置。例如,如果代理的任何证书颁发机构过期,您可能需要更新代理的网络地址,或者替换额外的信任捆绑包。

集群将代理配置应用到 control plane 和计算节点。在应用配置时,每个集群节点暂时处于不可调度状态,并排空其工作负载。每个节点都会作为进程的一部分重启。

前提条件

-

您已在安装主机上安装和配置了最新的 ROSA (

rosa) 和 OpenShift (oc) CLI。 - 您有一个在 VPC 中部署的 ROSA 集群。

流程

编辑集群配置以添加或删除集群范围代理详情:

$ rosa edit cluster \ --cluster $CLUSTER_NAME \ --additional-trust-bundle-file <path_to_ca_bundle_file> \1 2 3 --http-proxy http://<username>:<password>@<ip>:<port> \4 5 --https-proxy https://<username>:<password>@<ip>:<port> \6 7 --no-proxy example.com8 - 1 4 6

additional-trust-bundle-file、http-proxy和https-proxy参数都是可选。- 2

additional-trust-bundle-file参数是一个指向 PEM 编码 X.509 证书的捆绑包的文件路径,这些证书全部连接在一起。additional-trust-bundle-file 参数是一个指向 PEM 编码 X.509 证书的捆绑包的文件路径,它们都串联在一起。使用 TLS-inspecting 代理的用户需要 additional-trust-bundle-file 参数,除非代理的身份证书由 Red Hat Enterprise Linux CoreOS (RHCOS)信任捆绑包的颁发机构签名。无论代理是透明还是需要使用http-proxy和https-proxy参数明确配置,都适用。注意您不应该尝试在集群中直接更改代理或其他信任捆绑包配置。这些更改必须使用 ROSA CLI (

rosa) 或 Red Hat OpenShift Cluster Manager 加以应用。直接对集群所做的任何更改都会被自动恢复。- 3 5 7

http-proxy和https-proxy参数必须指向有效的 URL。- 8

- 要排除代理的目标域名、IP 地址或网络 CIDR 的逗号分隔列表。

在域前面加上

.以仅匹配子域。例如:.y.com匹配x.y.com,但不匹配y.com。使用*可对所有目的地绕过所有代理。如果您扩展了未包含在安装配置中networking.machineNetwork[].cidr字段定义的 worker,您必须将它们添加到此列表中,以防止连接问题。如果未设置

httpProxy或httpsProxy字段,则此字段将被忽略。

验证

列出机器配置池的状态,并验证它们是否已更新:

$ oc get machineconfigpools输出示例

NAME CONFIG UPDATED UPDATING DEGRADED MACHINECOUNT READYMACHINECOUNT UPDATEDMACHINECOUNT DEGRADEDMACHINECOUNT AGE master rendered-master-d9a03f612a432095dcde6dcf44597d90 True False False 3 3 3 0 31h worker rendered-worker-f6827a4efe21e155c25c21b43c46f65e True False False 6 6 6 0 31h显示集群的代理配置,并验证详情是否如预期:

$ oc get proxy cluster -o yaml输出示例

apiVersion: config.openshift.io/v1 kind: Proxy spec: httpProxy: http://proxy.host.domain:<port> httpsProxy: https://proxy.host.domain:<port> <...more...> status: httpProxy: http://proxy.host.domain:<port> httpsProxy: https://proxy.host.domain:<port> <...more...>

4.5. 删除集群范围代理

您可以使用 ROSA CLI 删除集群范围代理。删除集群后,您还应删除添加到集群的任何信任捆绑包。

4.5.1. 使用 CLI 删除集群范围代理

您必须使用 Red Hat OpenShift Service on AWS (ROSA) CLI rosa 从集群中删除代理地址。

前提条件

- 您必须具有集群管理员特权。

-

已安装 ROSA CLI (

rosa)。

流程

使用

rosa edit命令修改代理。您必须将空字符串传递给--http-proxy和--https-proxy参数,才能清除集群中的代理:$ rosa edit cluster -c <cluster_name> --http-proxy "" --https-proxy ""注意虽然代理可能只使用一个代理参数,但空字段将被忽略,因此将空字符串传递给

--http-proxy和--https-proxy参数不会造成任何问题。输出示例

I: Updated cluster <cluster_name>

验证

您可以使用

rosa describe命令验证代理是否已从集群中删除:$ rosa describe cluster -c <cluster_name>在删除前,代理 IP 会显示在 proxy 部分:

Name: <cluster_name> ID: <cluster_internal_id> External ID: <cluster_external_id> OpenShift Version: 4.0 Channel Group: stable DNS: <dns> AWS Account: <aws_account_id> API URL: <api_url> Console URL: <console_url> Region: us-east-1 Multi-AZ: false Nodes: - Control plane: 3 - Infra: 2 - Compute: 2 Network: - Type: OVNKubernetes - Service CIDR: <service_cidr> - Machine CIDR: <machine_cidr> - Pod CIDR: <pod_cidr> - Host Prefix: <host_prefix> Proxy: - HTTPProxy: <proxy_url> Additional trust bundle: REDACTED删除代理后,代理部分会被删除:

Name: <cluster_name> ID: <cluster_internal_id> External ID: <cluster_external_id> OpenShift Version: 4.0 Channel Group: stable DNS: <dns> AWS Account: <aws_account_id> API URL: <api_url> Console URL: <console_url> Region: us-east-1 Multi-AZ: false Nodes: - Control plane: 3 - Infra: 2 - Compute: 2 Network: - Type: OVNKubernetes - Service CIDR: <service_cidr> - Machine CIDR: <machine_cidr> - Pod CIDR: <pod_cidr> - Host Prefix: <host_prefix> Additional trust bundle: REDACTED

4.5.2. 删除 Red Hat OpenShift Service on AWS 集群上的证书颁发机构

您可以使用 Red Hat OpenShift Service on AWS (ROSA) CLI rosa 从集群中删除证书颁发机构(CA)。

前提条件

- 您必须具有集群管理员特权。

-

已安装 ROSA CLI (

rosa)。 - 集群添加了证书颁发机构。

流程

使用

rosa edit命令修改 CA 信任捆绑包。您必须将空字符串传递给--additional-trust-bundle-file参数,以便从集群中清除信任捆绑包:$ rosa edit cluster -c <cluster_name> --additional-trust-bundle-file ""输出示例

I: Updated cluster <cluster_name>

验证

您可以使用

rosa describe命令验证信任捆绑包是否已从集群中删除:$ rosa describe cluster -c <cluster_name>在删除前,会显示额外的信任捆绑包部分,以便将其值用于安全目的:

Name: <cluster_name> ID: <cluster_internal_id> External ID: <cluster_external_id> OpenShift Version: 4.0 Channel Group: stable DNS: <dns> AWS Account: <aws_account_id> API URL: <api_url> Console URL: <console_url> Region: us-east-1 Multi-AZ: false Nodes: - Control plane: 3 - Infra: 2 - Compute: 2 Network: - Type: OVNKubernetes - Service CIDR: <service_cidr> - Machine CIDR: <machine_cidr> - Pod CIDR: <pod_cidr> - Host Prefix: <host_prefix> Proxy: - HTTPProxy: <proxy_url> Additional trust bundle: REDACTED删除代理后,额外的信任捆绑包会被删除: