节点

Red Hat OpenShift Service on AWS 节点

摘要

第 1 章 节点概述

1.1. 关于节点

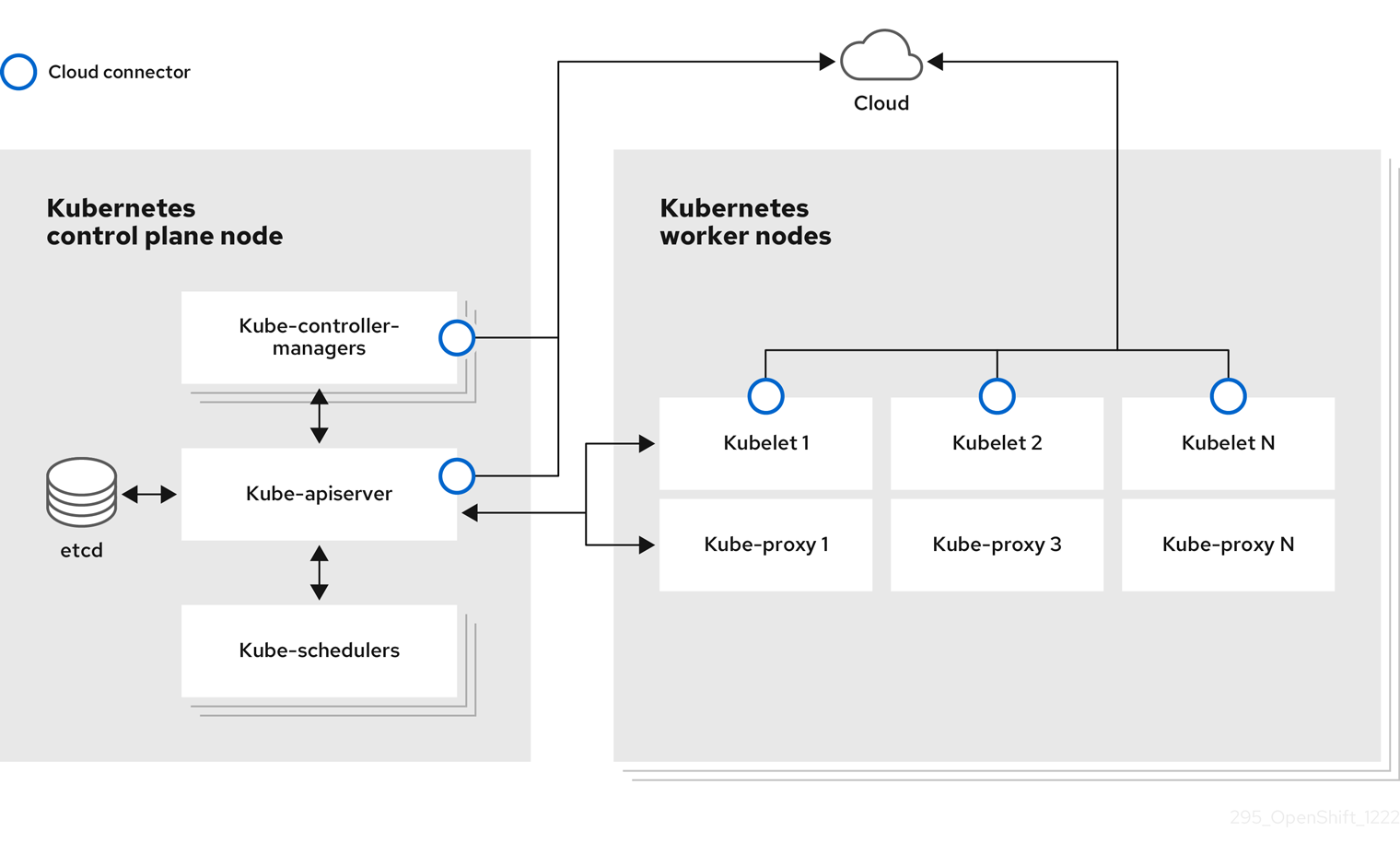

节点是 Kubernetes 集群中的虚拟机或裸机。Worker 节点托管您的应用程序容器,分组为 pod。control plane 节点运行控制 Kubernetes 集群所需的服务。在 Red Hat OpenShift Service on AWS 中,control plane 节点不仅仅包含用于管理 Red Hat OpenShift Service on AWS 集群的 Kubernetes 服务。

在集群中运行稳定和健康的节点是基本运行托管应用程序的基本操作。在 Red Hat OpenShift Service on AWS 中,您可以通过代表该节点的节点对象访问、管理和监控节点。使用 OpenShift CLI(oc)或 Web 控制台,您可以在节点上执行以下操作。

节点的以下组件负责维护运行 pod 并提供 Kubernetes 运行时环境。

- 容器运行时

- 容器运行时负责运行容器。Kubernetes 提供多个运行时,如 containerd、cri-o、rktlet 和 Docker。

- Kubelet

- kubelet 在节点上运行并读取容器清单。它确保定义的容器已启动且正在运行。kubelet 进程维护工作和节点服务器的状态。kubelet 管理网络流量和端口转发。kubelet 管理仅由 Kubernetes 创建的容器。

- Kube-proxy

- kube-proxy 在集群的每个节点上运行,并维护 Kubernetes 资源之间的网络流量。Kube-proxy 可确保网络环境被隔离并可访问。

- DNS

- 集群 DNS 是一个 DNS 服务器,它为 Kubernetes 服务提供 DNS 记录。由 Kubernetes 启动的容器会在其 DNS 搜索中自动包含此 DNS 服务器。

读取操作

通过读取操作,管理员或开发人员可获取有关 Red Hat OpenShift Service on AWS 集群中节点的信息。

- 列出集群中的所有节点。

- 获取节点的相关信息,如内存和 CPU 使用量、健康、状态和年龄。

- 列出节点上运行的 pod。

增强操作

Red Hat OpenShift Service on AWS 为您提供不仅仅是访问和管理节点的权限;作为管理员,您可以在节点上执行以下任务,使集群更高效、应用程序友好,并为开发人员提供更好的环境。

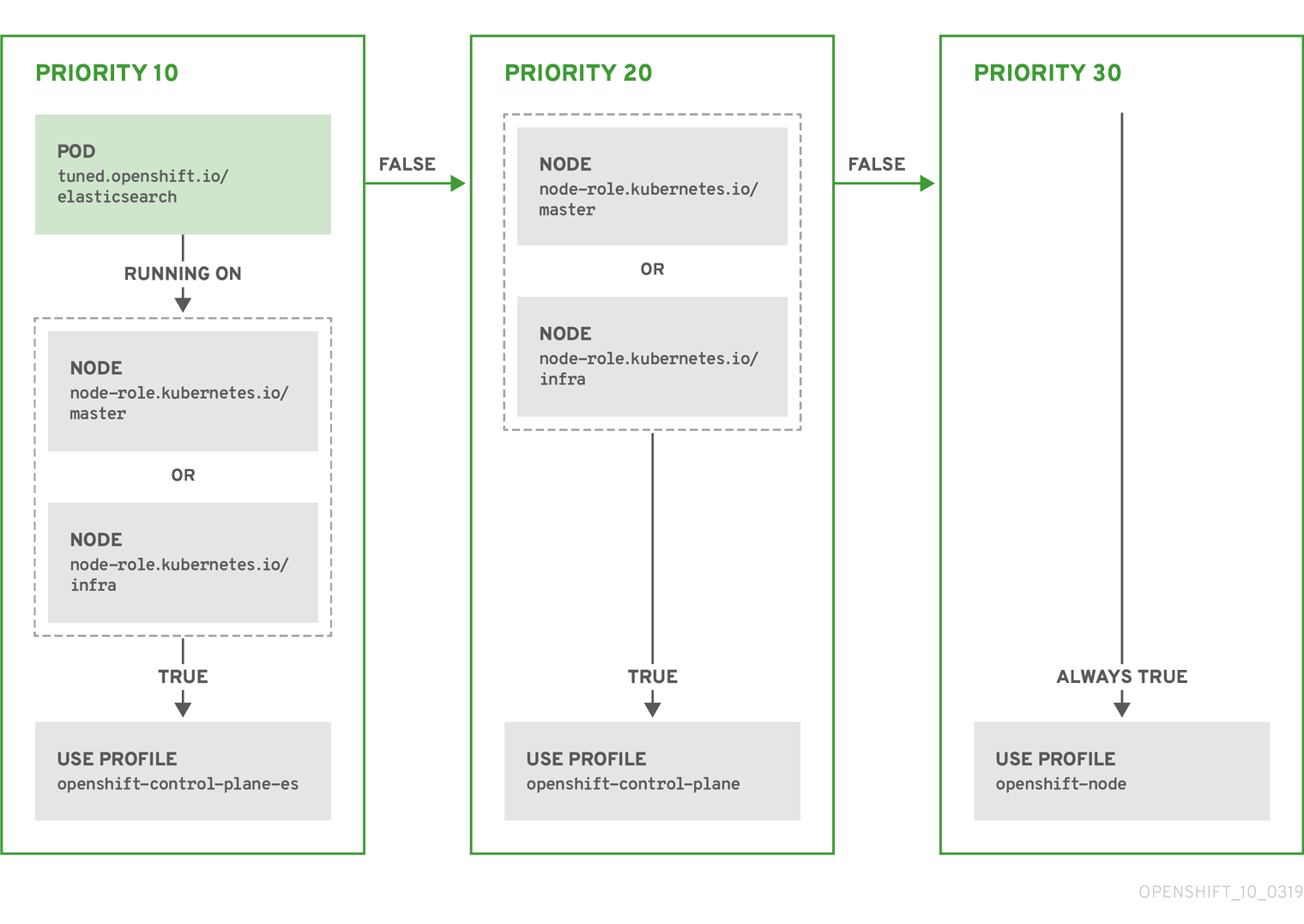

- 使用 Node Tuning Operator,为需要一定等级内核调整的高性能应用程序管理节点级别的性能优化。

- 使用守护进程集在节点上自动运行后台任务。您可以创建并使用守护进程集来创建共享存储,在每个节点上运行日志记录 pod,或者在所有节点上部署监控代理。

- 使用守护进程集在节点上自动运行后台任务。您可以创建并使用守护进程集来创建共享存储,在每个节点上运行日志记录 pod,或者在所有节点上部署监控代理。

1.2. 关于 pod

pod 是节点上共同部署的一个或多个容器。作为集群管理员,您可以定义 pod,为它分配在准备好调度和管理的健康节点上运行。只要容器正在运行,pod 就会运行。在 Pod 被定义并运行后,您无法更改它。使用 pod 时,您可以执行的一些操作包括:

读取操作

作为管理员,您可以通过以下任务来获取项目中的 pod 信息:

- 列出与项目关联的 pod,包括副本数、重启、当前状态和年龄等信息。

- 查看 pod 用量统计,如 CPU、内存和存储消耗。

管理操作

以下任务列表概述了管理员如何在 Red Hat OpenShift Service on AWS 集群中管理 pod。

使用 Red Hat OpenShift Service on AWS 中提供的高级调度功能控制 pod 调度:

- 节点到 pod 的绑定规则,如 pod 关联性、节点关联性 和 反关联性。

- 节点标签和选择器。

- Pod 拓扑分布约束。

- 配置 pod 如何使用 pod 控制器重启后的行为,然后重新启动策略。

- 限制 pod 上的出口和入口流量。

- 从具有 pod 模板的任何对象中添加和移除卷。卷是 pod 中所有容器使用的已挂载文件系统。容器存储是临时的;您可以使用卷来持久保留容器数据。

增强操作

您可以使用 Red Hat OpenShift Service on AWS 中提供的各种工具和功能,更轻松地使用 pod。以下操作涉及使用这些工具和功能来更好地管理 pod。

-

Secrets:有些应用程序需要敏感信息,如密码和用户名。管理员可以使用

Secret对象为 pod 提供机密数据,使用Secret对象。

1.3. 关于容器

容器是 Red Hat OpenShift Service on AWS 应用程序的基本单元,它由应用程序代码与其依赖项、库和二进制文件一起打包。容器提供不同环境间的一致性和多个部署目标:物理服务器、虚拟机 (VM) 和私有或公有云。

Linux 容器技术是一种轻量型机制,用于隔离运行中的进程,仅限制对指定的资源的访问。作为管理员,您可以在 Linux 容器上执行各种任务,例如:

Red Hat OpenShift Service on AWS 提供了一个名为 Init containers 的专用容器。init 容器在应用程序容器之前运行,可以包含应用程序镜像中不存在的工具或设置脚本。您可以在部署 pod 的其余部分之前,使用 Init 容器执行任务。

除了在节点、Pod 和容器上执行特定的任务外,您还可以与整个 Red Hat OpenShift Service on AWS 集群一起使用,以保持集群高效和应用程序 pod 具有高可用性。

1.4. Red Hat OpenShift Service on AWS 节点的常用术语表

该术语表定义了在节点内容中使用的常用术语。

- Container

- 它是一个轻量级且可执行的镜像,它包括了软件及其所有依赖项。容器虚拟化操作系统,因此您可以在任意位置运行容器,包括数据中心到公共或私有云,甚至在开发人员笔记本电脑中运行。

- 守护进程集

- 确保 pod 副本在 Red Hat OpenShift Service on AWS 集群的合格节点上运行。

- egress

- 通过来自 pod 的网络出站流量进行外部数据共享的过程。

- 垃圾回收

- 清理集群资源的过程,如终止的容器和未被任何正在运行的 Pod 引用的镜像。

- 入口

- 到一个 pod 的传入流量。

- 作业

- 要完成的进程。作业创建一个或多个 pod 对象,并确保指定的 pod 成功完成。

- 标签

- 您可以使用标签(即键值对)来组织并选择对象子集,如 pod。

- 节点

- Red Hat OpenShift Service on AWS 集群中的 worker 机器。节点可以是虚拟机 (VM) 或物理机器。

- Node Tuning Operator

- 您可以使用 Node Tuning Operator,使用 TuneD 守护进程来管理节点级别的性能优化。它保证了自定义性能优化设置以可被守护进程支持的格式传递到在集群中运行的所有容器化的 TuneD 守护进程中。相应的守护进程会在集群的所有节点上运行,每个节点上运行一个。

- 自助服务修复 Operator

- Operator 在集群节点上运行,并检测和重启不健康的节点。

- Pod

- 在 Red Hat OpenShift Service on AWS 集群中运行的一个或多个带有共享资源(如卷和 IP 地址)的容器。pod 是定义、部署和管理的最小计算单元。

- 容限(toleration)

- 表示 pod 允许(但不需要)调度到具有匹配污点的节点组。您可以使用容限来启用调度程序来调度具有匹配污点的 pod。

- 污点(taint)

- 一个核心对象,由一个键、值和效果组成。污点和容限可以一起工作,以确保 pod 不会调度到不相关的节点上。

第 2 章 使用 pod

2.1. 使用 pod

pod 是共同部署在同一主机上的一个或多个容器,也是可被定义、部署和管理的最小计算单元。

2.1.1. 了解 pod

对容器而言,Pod 大致相当于一个机器实例(物理或虚拟)。每个 pod 分配有自己的内部 IP 地址,因此拥有完整的端口空间,并且 pod 内的容器可以共享其本地存储和网络。

Pod 有生命周期,它们经过定义后,被分配到某一节点上运行,然后持续运行,直到容器退出或它们因为其他原因被删除为止。根据策略和退出代码,Pod 可在退出后删除,或被保留下来以启用对容器日志的访问。

Red Hat OpenShift Service on AWS 将 pod 视为不可变,在 pod 运行时无法对 pod 定义进行更改。Red Hat OpenShift Service on AWS 通过终止现有的 pod 并使用修改后的配置、基础镜像或两者重新创建它来实现更改。Pod 也被视为是可抛弃的,不会在重新创建时保持原来的状态。因此,pod 通常应通过更高级别的控制器来管理,而不直接由用户管理。

不受复制控制器管理的裸机 pod 不能在节点中断时重新调度。

2.1.2. pod 配置示例

Red Hat OpenShift Service on AWS 利用 Kubernetes 的 pod 概念,它是共同部署在同一主机上的一个或多个容器,也是可被定义、部署和管理的最小计算单元。

以下是 pod 的示例定义。它展示了 pod 的许多特性,其中大多数已在其他主题中阐述,因此这里仅简略提及:

Pod 对象定义(YAML)

kind: Pod

apiVersion: v1

metadata:

name: example

labels:

environment: production

app: abc 1

spec:

restartPolicy: Always 2

securityContext: 3

runAsNonRoot: true

seccompProfile:

type: RuntimeDefault

containers: 4

- name: abc

args:

- sleep

- "1000000"

volumeMounts: 5

- name: cache-volume

mountPath: /cache 6

image: registry.access.redhat.com/ubi7/ubi-init:latest 7

securityContext:

allowPrivilegeEscalation: false

runAsNonRoot: true

capabilities:

drop: ["ALL"]

resources:

limits:

memory: "100Mi"

cpu: "1"

requests:

memory: "100Mi"

cpu: "1"

volumes: 8

- name: cache-volume

emptyDir:

sizeLimit: 500Mi

- 1

- pod 可以被“标上”一个或多个标签,然后使用这些标签在一个操作中选择和管理多组 pod。标签以键/值格式保存在

metadata散列中。 - 2

- pod 重启策略,可能的值有

Always、OnFailure和Never。默认值为Always。 - 3

- Red Hat OpenShift Service on AWS 为容器定义了一个安全上下文,指定是否允许其作为特权容器运行,以所选用户身份运行,等等。默认上下文的限制性比较强,但管理员可以根据需要进行修改。

- 4

containers指定包括一个或多个容器定义的数组。- 5

- 容器指定在容器中挂载外部存储卷的位置。

- 6

- 指定要为 pod 提供的卷。卷挂载在指定路径上。不要挂载到容器 root、

/或主机和容器中相同的任何路径。如果容器有足够权限,可能会损坏您的主机系统(如主机的/dev/pts文件)。使用/host挂载主机是安全的。 - 7

- pod 中的每个容器使用自己的容器镜像进行实例化。

- 8

- pod 定义了可供其容器使用的存储卷。

如果将具有高文件数的持久性卷附加到 pod,则这些 pod 可能会失败,或者可能需要很长时间才能启动。如需更多信息,请参阅在 OpenShift 中使用具有高文件计数的持久性卷时,为什么 pod 无法启动或占用大量时间来实现"Ready"状态?

此 pod 定义不包括在 Pod 创建并开始生命周期后,Red Hat OpenShift Service on AWS 填充的属性。Kubernetes pod 文档详细介绍了 pod 的功能和用途。

2.1.3. 其他资源

2.2. 查看 pod

作为管理员,您可以查看集群中的 pod,并确定这些 pod 和整个集群的健康状态。

2.2.1. 关于 pod

Red Hat OpenShift Service on AWS 利用 Kubernetes 的 pod 概念,它是共同部署在同一主机上的一个或多个容器,也是可被定义、部署和管理的最小计算单元。对容器而言,Pod 大致相当于机器实例(物理或虚拟)。

您可以查看与特定项目关联的 pod 列表,或者查看 pod 的使用情况统计。

2.2.2. 查看项目中的 pod

您可以查看与当前项目关联的 pod 列表,包括副本数、当前状态、重启次数和 pod 的年龄。

流程

查看项目中的 pod:

切换到对应项目:

$ oc project <project-name>

运行以下命令:

$ oc get pods

例如:

$ oc get pods

输出示例

NAME READY STATUS RESTARTS AGE console-698d866b78-bnshf 1/1 Running 2 165m console-698d866b78-m87pm 1/1 Running 2 165m

添加

-o wide标记来查看 pod IP 地址和 pod 所在的节点。$ oc get pods -o wide

输出示例

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE console-698d866b78-bnshf 1/1 Running 2 166m 10.128.0.24 ip-10-0-152-71.ec2.internal <none> console-698d866b78-m87pm 1/1 Running 2 166m 10.129.0.23 ip-10-0-173-237.ec2.internal <none>

2.2.3. 查看 pod 用量统计

您可以显示 pod 的用量统计,这些统计信息为容器提供了运行时环境。这些用量统计包括 CPU、内存和存储的消耗。

先决条件

-

您必须有

cluster-reader权限才能查看用量统计。 - 必须安装 Metrics 才能查看用量统计。

流程

查看用量统计:

运行以下命令:

$ oc adm top pods

例如:

$ oc adm top pods -n openshift-console

输出示例

NAME CPU(cores) MEMORY(bytes) console-7f58c69899-q8c8k 0m 22Mi console-7f58c69899-xhbgg 0m 25Mi downloads-594fcccf94-bcxk8 3m 18Mi downloads-594fcccf94-kv4p6 2m 15Mi

运行以下命令,以查看带有标签的 pod 用量统计:

$ oc adm top pod --selector=''

您必须选择过滤所基于的选择器(标签查询)。支持

=、==和!=。例如:

$ oc adm top pod --selector='name=my-pod'

2.2.4. 查看资源日志

您可以在 OpenShift CLI (oc) 和 Web 控制台中查看各种资源的日志。日志从日志的尾部或末尾读取。

先决条件

-

访问 OpenShift CLI(

oc)。

流程 (UI)

在 Red Hat OpenShift Service on AWS 控制台中,进入 Workloads → Pods,或通过您要调查的资源导航到 pod。

注意有些资源(如构建)没有直接查询的 pod。在这种情况下,您可以在资源的 Details 页面中找到 Logs 链接。

- 从下拉菜单中选择一个项目。

- 点您要调查的 pod 的名称。

- 点 Logs。

流程 (CLI)

查看特定 pod 的日志:

$ oc logs -f <pod_name> -c <container_name>

其中:

-f- 可选:指定输出是否遵循要写到日志中的内容。

<pod_name>- 指定 pod 的名称。

<container_name>- 可选:指定容器的名称。当 pod 具有多个容器时,您必须指定容器名称。

例如:

$ oc logs ruby-58cd97df55-mww7r

$ oc logs -f ruby-57f7f4855b-znl92 -c ruby

输出的日志文件内容。

查看特定资源的日志:

$ oc logs <object_type>/<resource_name> 1- 1

- 指定资源类型和名称。

例如:

$ oc logs deployment/ruby

输出的日志文件内容。

2.3. 为 pod 配置 Red Hat OpenShift Service on AWS 集群

作为管理员,您可以为 pod 创建和维护高效的集群。

通过确保集群高效运行,您可以使用一些工具为开发人员提供更好的环境,例如,pod 退出时的行为,确保始终有所需数量的 pod 在运行,何时重启设计为只运行一次的 pod,限制 pod 可以使用的带宽,以及如何在中断时让 pod 保持运行。

2.3.1. 配置 pod 重启后的行为

Pod 重启策略决定 Red Hat OpenShift Service on AWS 在该 pod 中的容器退出时如何响应。该策略适用于 pod 中的所有容器。

可能的值有:

-

Always- 在 pod 被重启之前,按规定的延时值(10s,20s,40s)不断尝试重启 pod 中成功退出的容器(最长为 5 分钟)。默认值为Always。 -

OnFailure- 按规定的延时值(10s,20s,40s)不断尝试重启 pod 中失败的容器,上限为 5 分钟。 -

Never- 不尝试重启 pod 中已退出或失败的容器。Pod 立即失败并退出。

在 pod 绑定到某个节点后,该 pod 永远不会绑定到另一个节点。这意味着,需要一个控制器才能使 pod 在节点失败后存活:

| 状况 | 控制器类型 | 重启策略 |

|---|---|---|

| 应该终止的 Pod(例如,批量计算) | 作业 |

|

| 不应该终止的 Pod(例如,Web 服务器) | 复制控制器 |

|

| 每台机器必须运行一个的 Pod | 守护进程集 | 任意 |

如果 pod 上的容器失败且重启策略设为 OnFailure,则 pod 会保留在该节点上并重新启动容器。如果您不希望容器重新启动,请使用 Never 重启策略。

如果整个 pod 失败,Red Hat OpenShift Service on AWS 会启动新的 pod。开发人员必须解决应用程序可能会在新 pod 中重启的情况。特别是,应用程序必须处理由以往运行产生的临时文件、锁定、不完整输出等结果。

Kubernetes 架构需要来自云提供商的可靠端点。当云供应商停机时,kubelet 会阻止 Red Hat OpenShift Service on AWS 重启。

如果底层云提供商端点不可靠,请不要使用云提供商集成来安装集群。应像在非云环境中一样安装集群。不建议在已安装的集群中打开或关闭云提供商集成。

如需了解 Red Hat OpenShift Service on AWS 如何使用带有失败容器的重启策略,请参阅 Kubernetes 文档中的示例状态。

2.3.2. 限制可供 pod 使用的带宽

您可以对 pod 应用服务质量流量控制,有效限制其可用带宽。出口流量(从 pod 传出)按照策略来处理,仅在超出配置的速率时丢弃数据包。入口流量(传入 pod 中)通过控制已排队数据包进行处理,以便有效地处理数据。您对 pod 应用的限制不会影响其他 pod 的带宽。

流程

限制 pod 的带宽:

编写对象定义 JSON 文件,并使用

kubernetes.io/ingress-bandwidth和kubernetes.io/egress-bandwidth注解指定数据流量速度。例如,将 pod 出口和入口带宽限制为 10M/s:受限

Pod对象定义{ "kind": "Pod", "spec": { "containers": [ { "image": "openshift/hello-openshift", "name": "hello-openshift" } ] }, "apiVersion": "v1", "metadata": { "name": "iperf-slow", "annotations": { "kubernetes.io/ingress-bandwidth": "10M", "kubernetes.io/egress-bandwidth": "10M" } } }使用对象定义创建 pod:

$ oc create -f <file_or_dir_path>

2.3.3. 了解如何使用 pod 中断预算来指定必须在线的 pod 数量

pod 中断预算允许在操作过程中指定 pod 的安全限制,如排空节点以进行维护。

PodDisruptionBudget 是一个 API 对象,用于指定在某一时间必须保持在线的副本的最小数量或百分比。在项目中进行这些设置对节点维护(比如缩减集群或升级集群)有益,而且仅在自愿驱除(而非节点失败)时遵从这些设置。

PodDisruptionBudget 对象的配置由以下关键部分组成:

- 标签选择器,即一组 pod 的标签查询。

可用性级别,用来指定必须同时可用的最少 pod 的数量:

-

minAvailable是必须始终可用的 pod 的数量,即使在中断期间也是如此。 -

maxUnavailable是中断期间可以无法使用的 pod 的数量。

-

Available 指的是具有 Ready=True 的 pod 数量。ready=True 指的是能够服务请求的 pod,并应添加到所有匹配服务的负载平衡池中。

允许 maxUnavailable 为 0% 或 0,minAvailable 为 100% 或等于副本数,但这样设置可能会阻止节点排空操作。

对于 Red Hat OpenShift Service on AWS 中的所有机器配置池,maxUnavailable 的默认设置是 1。建议您不要更改这个值,且一次只更新一个 control plane 节点。对于 control plane 池,请不要将这个值改为 3。

您可以使用以下命令来检查所有项目的 pod 中断预算:

$ oc get poddisruptionbudget --all-namespaces

以下示例包含特定于 AWS 上的 Red Hat OpenShift Service 的一些值。

输出示例

NAMESPACE NAME MIN AVAILABLE MAX UNAVAILABLE ALLOWED DISRUPTIONS AGE openshift-apiserver openshift-apiserver-pdb N/A 1 1 121m openshift-cloud-controller-manager aws-cloud-controller-manager 1 N/A 1 125m openshift-cloud-credential-operator pod-identity-webhook 1 N/A 1 117m openshift-cluster-csi-drivers aws-ebs-csi-driver-controller-pdb N/A 1 1 121m openshift-cluster-storage-operator csi-snapshot-controller-pdb N/A 1 1 122m openshift-cluster-storage-operator csi-snapshot-webhook-pdb N/A 1 1 122m openshift-console console N/A 1 1 116m #...

如果系统中至少有 minAvailable 个 pod 正在运行,则 PodDisruptionBudget 被视为是健康的。超过这一限制的每个 pod 都可被驱除。

根据您的 pod 优先级与抢占设置,可能会无视 pod 中断预算要求而移除较低优先级 pod。

2.3.3.1. 使用 pod 中断预算指定必须在线的 pod 数量

您可以使用 PodDisruptionBudget 对象来指定某一时间必须保持在线的副本的最小数量或百分比。

流程

配置 pod 中断预算:

使用类似以下示例的对象定义来创建 YAML 文件:

apiVersion: policy/v1 1 kind: PodDisruptionBudget metadata: name: my-pdb spec: minAvailable: 2 2 selector: 3 matchLabels: name: my-pod

或者:

apiVersion: policy/v1 1 kind: PodDisruptionBudget metadata: name: my-pdb spec: maxUnavailable: 25% 2 selector: 3 matchLabels: name: my-pod

运行以下命令,将对象添加到项目中:

$ oc create -f </path/to/file> -n <project_name>

2.4. 使用 secret 为 pod 提供敏感数据

其他资源

有些应用程序需要密码和用户名等敏感信息,但您不希望开发人员持有这些信息。

作为管理员,您可以使用 Secret 对象在不以明文方式公开的前提下提供此类信息。

2.4.1. 了解 secret

Secret 对象类型提供了一种机制来保存敏感信息,如密码、Red Hat OpenShift Service on AWS 客户端配置文件和私有源存储库凭证等。secret 将敏感内容与 Pod 分离。您可以使用卷插件将 secret 信息挂载到容器中,系统也可以使用 secret 代表 Pod 执行操作。

主要属性包括:

- Secret 数据可以独立于其定义来引用。

- Secret 数据卷由临时文件工具 (tmpfs) 支持,永远不会停留在节点上。

- secret 数据可以在命名空间内共享。

YAML Secret 对象定义

apiVersion: v1 kind: Secret metadata: name: test-secret namespace: my-namespace type: Opaque 1 data: 2 username: <username> 3 password: <password> stringData: 4 hostname: myapp.mydomain.com 5

您必须先创建 secret,然后创建依赖于此 secret 的 Pod。

在创建 secret 时:

- 使用 secret 数据创建 secret 对象。

- 更新 pod 的服务帐户以允许引用该 secret。

-

创建以环境变量或文件(使用

secret卷)形式消耗 secret 的 pod。

2.4.1.1. secret 的类型

type 字段中的值指明 secret 的键名称和值的结构。此类型可用于强制使 secret 对象中存在用户名和密钥。如果您不想进行验证,请使用 opaque 类型,这也是默认类型。

指定以下一种类型来触发最小服务器端验证,确保 secret 数据中存在特定的键名称:

-

kubernetes.io/basic-auth:使用基本身份验证 -

kubernetes.io/dockercfg:用作镜像 pull secret -

kubernetes.io/dockerconfigjson: 用作镜像 pull secret -

kubernetes.io/service-account-token:用来获取旧的服务帐户 API 令牌 -

kubernetes.io/ssh-auth:与 SSH 密钥身份验证一起使用 -

kubernetes.io/tls:与 TLS 证书颁发机构一起使用

如果您不想要验证,请指定 type: Opaque,即 secret 没有声明键名称或值需要符合任何约定。opaque secret 允许使用无结构 key:value 对,可以包含任意值。

您可以指定其他任意类型,如 example.com/my-secret-type。这些类型不是在服务器端强制执行,而是表明 secret 的创建者意在符合该类型的键/值要求。

有关创建不同类型的 secret 的示例,请参阅 了解如何创建 secret。

2.4.1.2. Secret 数据密钥

Secret 密钥必须在 DNS 子域中。

2.4.1.3. 自动生成的镜像 pull secret

默认情况下,Red Hat OpenShift Service on AWS 为每个服务帐户创建一个镜像 pull secret。

在 Red Hat OpenShift Service on AWS 4.16 之前,还会为每个创建的服务帐户 API 令牌 secret 生成长期服务帐户令牌 secret。从 Red Hat OpenShift Service on AWS 4.16 开始,不再创建此服务帐户 API 令牌 secret。

升级到 4 后,任何现有的长期服务帐户 API 令牌 secret 不会被删除,并将继续正常工作。有关检测集群中使用的长期 API 令牌,以及在不需要时删除它们的信息,请参阅红帽知识库文章 OpenShift Container Platform 中的 Long-lived 服务帐户 API 令牌。

此镜像 pull secret 需要将 OpenShift 镜像 registry 集成到集群的用户身份验证和授权系统中。

但是,如果您不启用 ImageRegistry 功能,或者在 Cluster Image Registry Operator 配置中禁用集成的 OpenShift 镜像 registry,则不会为每个服务帐户生成镜像 pull secret。

当在之前启用的集群中禁用集成的 OpenShift 镜像 registry 时,之前生成的镜像 pull secret 会被自动删除。

2.4.2. 了解如何创建 secret

作为管理员,您必须先创建 secret,然后开发人员才能创建依赖于该 secret 的 pod。

在创建 secret 时:

创建包含您要保留 secret 的数据的 secret 对象。在以下部分中取消每个 secret 类型所需的特定数据。

创建不透明 secret 的 YAML 对象示例

apiVersion: v1 kind: Secret metadata: name: test-secret type: Opaque 1 data: 2 username: <username> password: <password> stringData: 3 hostname: myapp.mydomain.com secret.properties: | property1=valueA property2=valueB

使用

data或stringdata字段,不能同时使用这两个字段。更新 pod 的服务帐户以引用 secret:

使用 secret 的服务帐户的 YAML

apiVersion: v1 kind: ServiceAccount ... secrets: - name: test-secret

创建以环境变量或文件(使用

secret卷)形式消耗 secret 的 pod:pod 的 YAML 使用 secret 数据填充卷中的文件

apiVersion: v1 kind: Pod metadata: name: secret-example-pod spec: securityContext: runAsNonRoot: true seccompProfile: type: RuntimeDefault containers: - name: secret-test-container image: busybox command: [ "/bin/sh", "-c", "cat /etc/secret-volume/*" ] volumeMounts: 1 - name: secret-volume mountPath: /etc/secret-volume 2 readOnly: true 3 securityContext: allowPrivilegeEscalation: false capabilities: drop: [ALL] volumes: - name: secret-volume secret: secretName: test-secret 4 restartPolicy: Neverpod 的 YAML 使用 secret 数据填充环境变量

apiVersion: v1 kind: Pod metadata: name: secret-example-pod spec: securityContext: runAsNonRoot: true seccompProfile: type: RuntimeDefault containers: - name: secret-test-container image: busybox command: [ "/bin/sh", "-c", "export" ] env: - name: TEST_SECRET_USERNAME_ENV_VAR valueFrom: secretKeyRef: 1 name: test-secret key: username securityContext: allowPrivilegeEscalation: false capabilities: drop: [ALL] restartPolicy: Never- 1

- 指定消耗 secret 密钥的环境变量。

构建配置的 YAML 使用 secret 数据填充环境变量

apiVersion: build.openshift.io/v1 kind: BuildConfig metadata: name: secret-example-bc spec: strategy: sourceStrategy: env: - name: TEST_SECRET_USERNAME_ENV_VAR valueFrom: secretKeyRef: 1 name: test-secret key: username from: kind: ImageStreamTag namespace: openshift name: 'cli:latest'- 1

- 指定消耗 secret 密钥的环境变量。

2.4.2.1. Secret 创建限制

若要使用 secret,pod 需要引用该 secret。可以通过三种方式将 secret 用于 Pod:

- 为容器产生环境变量。

- 作为挂载到一个或多个容器上的卷中的文件。

- 在拉取 Pod 的镜像时通过 kubelet 使用。

卷类型 secret 使用卷机制将数据作为文件写入到容器中。镜像拉取 secret 使用服务帐户,将 secret 自动注入到命名空间中的所有 pod。

当模板包含 secret 定义时,模板使用提供的 secret 的唯一方法是确保验证 secret 卷源通过验证,并且指定的对象引用实际指向 Secret 类型的对象。因此,secret 需要在依赖它的任何 Pod 之前创建。确保这一点的最有效方法是通过使用服务帐户自动注入。

Secret API 对象驻留在命名空间中。它们只能由同一命名空间中的 pod 引用。

每个 secret 的大小限制为 1MB。这是为了防止创建可能会耗尽 apiserver 和 kubelet 内存的大型 secret。不过,创建许多较小的 secret 也可能会耗尽内存。

2.4.2.2. 创建不透明 secret

作为管理员,您可以创建一个不透明 secret,它允许您存储包含任意值的无结构 key:value 对。

流程

在 YAML 文件中创建

Secret对象。例如:

apiVersion: v1 kind: Secret metadata: name: mysecret type: Opaque 1 data: username: <username> password: <password>- 1

- 指定不透明 secret。

使用以下命令来创建

Secret对象:$ oc create -f <filename>.yaml

在 pod 中使用该 secret:

- 更新 pod 的服务帐户以引用 secret,如 "Understanding how to create secrets" 部分所示。

-

创建以环境变量或文件(使用 secret 卷)形式消耗

secret的 pod,如"创建 secret"部分所示。

其他资源

2.4.2.3. 创建旧的服务帐户令牌 secret

作为管理员,您可以创建一个旧的服务帐户令牌 secret,该 secret 允许您将服务帐户令牌分发到必须通过 API 进行身份验证的应用程序。

建议您使用 TokenRequest API 获取绑定的服务帐户令牌,而不使用旧的服务帐户令牌 secret。只有在无法使用 TokenRequest API 且在可读的 API 对象中存在非过期令牌时,才应创建服务帐户令牌 secret。

绑定服务帐户令牌比服务帐户令牌 secret 更安全,原因如下:

- 绑定服务帐户令牌具有绑定的生命周期。

- 绑定服务帐户令牌包含受众。

- 绑定服务帐户令牌可以绑定到 pod 或 secret,绑定令牌在删除绑定对象时无效。

工作负载自动注入投射卷以获取绑定服务帐户令牌。如果您的工作负载需要额外的服务帐户令牌,请在工作负载清单中添加额外的投射卷。

如需更多信息,请参阅"使用卷投射配置绑定服务帐户令牌"。

流程

在 YAML 文件中创建

Secret对象:Secret对象示例apiVersion: v1 kind: Secret metadata: name: secret-sa-sample annotations: kubernetes.io/service-account.name: "sa-name" 1 type: kubernetes.io/service-account-token 2使用以下命令来创建

Secret对象:$ oc create -f <filename>.yaml

在 pod 中使用该 secret:

- 更新 pod 的服务帐户以引用 secret,如 "Understanding how to create secrets" 部分所示。

-

创建以环境变量或文件(使用 secret 卷)形式消耗

secret的 pod,如"创建 secret"部分所示。

其他资源

2.4.2.4. 创建基本身份验证 secret

作为管理员,您可以创建一个基本身份验证 secret,该 secret 允许您存储基本身份验证所需的凭证。在使用此 secret 类型时,Secret 对象的 data 参数必须包含以下密钥,采用 base64 格式编码:

-

用户名:用于身份验证的用户名 -

密码:用于身份验证的密码或令牌

您可以使用 stringData 参数使用明文内容。

流程

在 YAML 文件中创建

Secret对象:secret对象示例apiVersion: v1 kind: Secret metadata: name: secret-basic-auth type: kubernetes.io/basic-auth 1 data: stringData: 2 username: admin password: <password>

使用以下命令来创建

Secret对象:$ oc create -f <filename>.yaml

在 pod 中使用该 secret:

- 更新 pod 的服务帐户以引用 secret,如 "Understanding how to create secrets" 部分所示。

-

创建以环境变量或文件(使用 secret 卷)形式消耗

secret的 pod,如"创建 secret"部分所示。

其他资源

2.4.2.5. 创建 SSH 身份验证 secret

作为管理员,您可以创建一个 SSH 验证 secret,该 secret 允许您存储用于 SSH 验证的数据。在使用此 secret 类型时,Secret 对象的 data 参数必须包含要使用的 SSH 凭证。

流程

在控制平面节点上的 YAML 文件中创建

Secret对象:secret对象示例apiVersion: v1 kind: Secret metadata: name: secret-ssh-auth type: kubernetes.io/ssh-auth 1 data: ssh-privatekey: | 2 MIIEpQIBAAKCAQEAulqb/Y ...

使用以下命令来创建

Secret对象:$ oc create -f <filename>.yaml

在 pod 中使用该 secret:

- 更新 pod 的服务帐户以引用 secret,如 "Understanding how to create secrets" 部分所示。

-

创建以环境变量或文件(使用 secret 卷)形式消耗

secret的 pod,如"创建 secret"部分所示。

其他资源

2.4.2.6. 创建 Docker 配置 secret

作为管理员,您可以创建一个 Docker 配置 secret,该 secret 允许您存储用于访问容器镜像 registry 的凭证。

-

kubernetes.io/dockercfg。使用此机密类型存储本地 Docker 配置文件。secret对象的data参数必须包含以 base64 格式编码的.dockercfg文件的内容。 -

kubernetes.io/dockerconfigjson。使用此机密类型存储本地 Docker 配置 JSON 文件。secret对象的data参数必须包含以 base64 格式编码的.docker/config.json文件的内容。

流程

在 YAML 文件中创建

Secret对象。Docker 配置

secret对象示例apiVersion: v1 kind: Secret metadata: name: secret-docker-cfg namespace: my-project type: kubernetes.io/dockerconfig 1 data: .dockerconfig:bm5ubm5ubm5ubm5ubm5ubm5ubm5ubmdnZ2dnZ2dnZ2dnZ2dnZ2dnZ2cgYXV0aCBrZXlzCg== 2

Docker 配置 JSON

secret对象示例apiVersion: v1 kind: Secret metadata: name: secret-docker-json namespace: my-project type: kubernetes.io/dockerconfig 1 data: .dockerconfigjson:bm5ubm5ubm5ubm5ubm5ubm5ubm5ubmdnZ2dnZ2dnZ2dnZ2dnZ2dnZ2cgYXV0aCBrZXlzCg== 2

使用以下命令来创建

Secret对象$ oc create -f <filename>.yaml

在 pod 中使用该 secret:

- 更新 pod 的服务帐户以引用 secret,如 "Understanding how to create secrets" 部分所示。

-

创建以环境变量或文件(使用 secret 卷)形式消耗

secret的 pod,如"创建 secret"部分所示。

其他资源

2.4.2.7. 使用 Web 控制台创建 secret

您可以使用 Web 控制台创建 secret。

流程

- 导航到 Workloads → Secrets。

点 Create → From YAML。

手动编辑您的规格的 YAML,或者将文件拖放到 YAML 编辑器。例如:

apiVersion: v1 kind: Secret metadata: name: example namespace: <namespace> type: Opaque 1 data: username: <base64 encoded username> password: <base64 encoded password> stringData: 2 hostname: myapp.mydomain.com

- 点 Create。

点 Add Secret to workload。

- 从下拉菜单中选择要添加的工作负载。

- 点击 Save。

2.4.3. 了解如何更新 secret

修改 secret 值时,值(由已在运行的 pod 使用)不会动态更改。若要更改 secret,您必须删除原始 pod 并创建一个新 pod(可能具有相同的 PodSpec)。

更新 secret 遵循与部署新容器镜像相同的工作流程。您可以使用 kubectl rolling-update 命令。

secret 中的 resourceVersion 值不在引用时指定。因此,如果在 pod 启动的同时更新 secret,则将不能定义用于 pod 的 secret 版本。

目前,无法检查 Pod 创建时使用的 secret 对象的资源版本。按照计划 Pod 将报告此信息,以便控制器可以重启使用旧 resourceVersion 的 Pod。在此期间,请勿更新现有 secret 的数据,而应创建具有不同名称的新数据。

2.4.4. 创建和使用 secret

作为管理员,您可以创建一个服务帐户令牌 secret。这可让您将服务帐户令牌分发到必须通过 API 进行身份验证的应用程序。

流程

运行以下命令,在命名空间中创建服务帐户:

$ oc create sa <service_account_name> -n <your_namespace>

将以下 YAML 示例保存到名为

service-account-token-secret.yaml的文件中。这个示例包括可用于生成服务帐户令牌的Secret对象配置:apiVersion: v1 kind: Secret metadata: name: <secret_name> 1 annotations: kubernetes.io/service-account.name: "sa-name" 2 type: kubernetes.io/service-account-token 3

通过应用文件来生成服务帐户令牌:

$ oc apply -f service-account-token-secret.yaml

运行以下命令,从 secret 获取服务帐户令牌:

$ oc get secret <sa_token_secret> -o jsonpath='{.data.token}' | base64 --decode 1输出示例

ayJhbGciOiJSUzI1NiIsImtpZCI6IklOb2dtck1qZ3hCSWpoNnh5YnZhSE9QMkk3YnRZMVZoclFfQTZfRFp1YlUifQ.eyJpc3MiOiJrdWJlcm5ldGVzL3NlcnZpY2VhY2NvdW50Iiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9uYW1lc3BhY2UiOiJkZWZhdWx0Iiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9zZWNyZXQubmFtZSI6ImJ1aWxkZXItdG9rZW4tdHZrbnIiLCJrdWJlcm5ldGVzLmlvL3NlcnZpY2VhY2NvdW50L3NlcnZpY2UtYWNjb3VudC5uYW1lIjoiYnVpbGRlciIsImt1YmVybmV0ZXMuaW8vc2VydmljZWFjY291bnQvc2VydmljZS1hY2NvdW50LnVpZCI6IjNmZGU2MGZmLTA1NGYtNDkyZi04YzhjLTNlZjE0NDk3MmFmNyIsInN1YiI6InN5c3RlbTpzZXJ2aWNlYWNjb3VudDpkZWZhdWx0OmJ1aWxkZXIifQ.OmqFTDuMHC_lYvvEUrjr1x453hlEEHYcxS9VKSzmRkP1SiVZWPNPkTWlfNRp6bIUZD3U6aN3N7dMSN0eI5hu36xPgpKTdvuckKLTCnelMx6cxOdAbrcw1mCmOClNscwjS1KO1kzMtYnnq8rXHiMJELsNlhnRyyIXRTtNBsy4t64T3283s3SLsancyx0gy0ujx-Ch3uKAKdZi5iT-I8jnnQ-ds5THDs2h65RJhgglQEmSxpHrLGZFmyHAQI-_SjvmHZPXEc482x3SkaQHNLqpmrpJorNqh1M8ZHKzlujhZgVooMvJmWPXTb2vnvi3DGn2XI-hZxl1yD2yGH1RBpYUHA

- 1

- 将 <sa_token_secret> 替换为服务帐户令牌 secret 的名称。

使用您的服务帐户令牌与集群的 API 进行身份验证:

$ curl -X GET <openshift_cluster_api> --header "Authorization: Bearer <token>" 1 2

2.4.5. 关于将签名证书与 secret 搭配使用

要保护与服务的通信,您可以配置 Red Hat OpenShift Service on AWS 来生成可添加到项目中的 secret 的已签名的服务证书/密钥对。

服务用证书 secret 旨在支持需要开箱即用证书的复杂中间件应用程序。它的设置与管理员工具为节点和 master 生成的服务器证书相同。

为服务用证书 secret 配置的服务 Pod 规格。

apiVersion: v1

kind: Service

metadata:

name: registry

annotations:

service.beta.openshift.io/serving-cert-secret-name: registry-cert1

# ...

- 1

- 指定证书的名称

其他 pod 可以信任集群创建的证书(仅对内部 DNS 名称进行签名),方法是使用 pod 中自动挂载的 /var/run/secrets/kubernetes.io/serviceaccount/service-ca.crt 文件中的 CA 捆绑。

此功能的签名算法是 x509.SHA256WithRSA。要手动轮转,请删除生成的 secret。这会创建新的证书。

2.4.5.1. 生成签名证书以便与 secret 搭配使用

要将签名的服务用证书/密钥对用于 pod,请创建或编辑服务以添加到 service.beta.openshift.io/serving-cert-secret-name 注解,然后将 secret 添加到该 pod。

流程

创建服务用证书 secret:

-

编辑服务的

Podspec。 使用您要用于 secret 的名称,添加

service.beta.openshift.io/serving-cert-secret-name注解。kind: Service apiVersion: v1 metadata: name: my-service annotations: service.beta.openshift.io/serving-cert-secret-name: my-cert 1 spec: selector: app: MyApp ports: - protocol: TCP port: 80 targetPort: 9376证书和密钥采用 PEM 格式,分别存储在

tls.crt和tls.key中。创建服务:

$ oc create -f <file-name>.yaml

查看 secret 以确保已成功创建:

查看所有 secret 列表:

$ oc get secrets

输出示例

NAME TYPE DATA AGE my-cert kubernetes.io/tls 2 9m

查看您的 secret 详情:

$ oc describe secret my-cert

输出示例

Name: my-cert Namespace: openshift-console Labels: <none> Annotations: service.beta.openshift.io/expiry: 2023-03-08T23:22:40Z service.beta.openshift.io/originating-service-name: my-service service.beta.openshift.io/originating-service-uid: 640f0ec3-afc2-4380-bf31-a8c784846a11 service.beta.openshift.io/expiry: 2023-03-08T23:22:40Z Type: kubernetes.io/tls Data ==== tls.key: 1679 bytes tls.crt: 2595 bytes

编辑与该 secret 搭配的

Podspec。apiVersion: v1 kind: Pod metadata: name: my-service-pod spec: securityContext: runAsNonRoot: true seccompProfile: type: RuntimeDefault containers: - name: mypod image: redis volumeMounts: - name: my-container mountPath: "/etc/my-path" securityContext: allowPrivilegeEscalation: false capabilities: drop: [ALL] volumes: - name: my-volume secret: secretName: my-cert items: - key: username path: my-group/my-username mode: 511当它可用时,您的 Pod 就可运行。该证书对内部服务 DNS 名称

<service.name>.<service.namespace>.svc有效。证书/密钥对在接近到期时自动替换。在 secret 的

service.beta.openshift.io/expiry注解中查看过期日期,其格式为 RFC3339。注意在大多数情形中,服务 DNS 名称

<service.name>.<service.namespace>.svc不可从外部路由。<service.name>.<service.namespace>.svc的主要用途是集群内或服务内通信,也用于重新加密路由。

2.4.6. secret 故障排除

如果服务证书生成失败并显示以下信息( 服务的 service.beta.openshift.io/serving-cert-generation-error 注解包含):

secret/ssl-key references serviceUID 62ad25ca-d703-11e6-9d6f-0e9c0057b608, which does not match 77b6dd80-d716-11e6-9d6f-0e9c0057b60

生成证书的服务不再存在,或者具有不同的 serviceUID 。您必须删除旧 secret 并清除服务上的以下注解 service.beta.openshift.io/serving-cert-generation-error, service.beta.openshift.io/serving-cert-generation-error-num 以强制重新生成证书:

删除 secret:

$ oc delete secret <secret_name>

清除注解:

$ oc annotate service <service_name> service.beta.openshift.io/serving-cert-generation-error-

$ oc annotate service <service_name> service.beta.openshift.io/serving-cert-generation-error-num-

在用于移除注解的命令中,要移除的注解后面有一个 -。

2.5. 创建和使用配置映射

以下部分定义配置映射以及如何创建和使用它们。

2.5.1. 了解配置映射

许多应用程序需要使用配置文件、命令行参数和环境变量的某些组合来进行配置。在 Red Hat OpenShift Service on AWS 中,这些配置工件与镜像内容分离,以便使容器化应用程序可以移植。

ConfigMap 对象提供将容器注入配置数据的机制,同时保持容器与 Red Hat OpenShift Service on AWS 无关。配置映射可用于存储细粒度信息(如个别属性)或粗粒度信息(如完整配置文件或 JSON blob)。

ConfigMap 对象包含配置数据的键值对,这些数据可在 Pod 中消耗或用于存储控制器等系统组件的配置数据。例如:

ConfigMap 对象定义

kind: ConfigMap apiVersion: v1 metadata: creationTimestamp: 2016-02-18T19:14:38Z name: example-config namespace: my-namespace data: 1 example.property.1: hello example.property.2: world example.property.file: |- property.1=value-1 property.2=value-2 property.3=value-3 binaryData: bar: L3Jvb3QvMTAw 2

从二进制文件(如镜像)创建配置映射时,您可以使用 binaryData 字段。

可以在 Pod 中以各种方式消耗配置数据。配置映射可用于:

- 在容器中填充环境变量值

- 设置容器中的命令行参数

- 填充卷中的配置文件

用户和系统组件可以在配置映射中存储配置数据。

配置映射与 secret 类似,但设计为能更加便捷地支持与不含敏感信息的字符串配合。

配置映射限制

在 pod 中可以消耗它的内容前,必须创建配置映射。

可以编写控制器来容许缺少的配置数据。根据具体情况使用配置映射来参考各个组件。

ConfigMap 对象驻留在一个项目中。

它们只能被同一项目中的 pod 引用。

Kubelet 只支持为它从 API 服务器获取的 pod 使用配置映射。

这包括使用 CLI 创建或间接从复制控制器创建的 pod。它不包括使用 Red Hat OpenShift Service on AWS 节点的 --manifest-url 标志、its- config 标志或其 REST API 创建的 pod,因为这些不是创建 pod 的通用方法。

2.5.2. 在 Red Hat OpenShift Service on AWS Web 控制台中创建配置映射

您可以在 Red Hat OpenShift Service on AWS Web 控制台中创建配置映射。

流程

以集群管理员身份创建配置映射:

-

在 Administrator 视角中,选择

Workloads→Config Maps。 - 在该页面右上方选择 Create Config Map。

- 输入配置映射的内容。

- 选择 Create。

-

在 Administrator 视角中,选择

以开发者身份创建配置映射:

-

在 Developer 视角中,选择

Config Maps。 - 在该页面右上方选择 Create Config Map。

- 输入配置映射的内容。

- 选择 Create。

-

在 Developer 视角中,选择

2.5.3. 使用 CLI 创建配置映射

您可以使用以下命令从目录、特定文件或文字值创建配置映射。

流程

创建配置映射:

$ oc create configmap <configmap_name> [options]

2.5.3.1. 从目录创建配置映射

您可以使用 --from-file 标志从目录创建配置映射。这个方法允许您使用目录中的多个文件来创建配置映射。

目录中的每个文件用于在配置映射中填充键,其中键的名称是文件名,键的值是文件的内容。

例如,以下命令会创建一个带有 example-files 目录内容的配置映射:

$ oc create configmap game-config --from-file=example-files/

查看配置映射中的密钥:

$ oc describe configmaps game-config

输出示例

Name: game-config Namespace: default Labels: <none> Annotations: <none> Data game.properties: 158 bytes ui.properties: 83 bytes

您可以看到,映射中的两个键都是从命令中指定的目录中的文件名创建的。这些密钥的内容可能非常大,因此 oc describe 的输出只显示键的名称及其大小。

前提条件

您必须有一个目录,其中包含您要使用填充配置映射的数据的文件。

以下流程使用这些示例文件:

game.properties和ui.properties:$ cat example-files/game.properties

输出示例

enemies=aliens lives=3 enemies.cheat=true enemies.cheat.level=noGoodRotten secret.code.passphrase=UUDDLRLRBABAS secret.code.allowed=true secret.code.lives=30

$ cat example-files/ui.properties

输出示例

color.good=purple color.bad=yellow allow.textmode=true how.nice.to.look=fairlyNice

流程

输入以下命令,创建包含此目录中每个文件内容的配置映射:

$ oc create configmap game-config \ --from-file=example-files/

验证

使用带有

-o选项的oc get命令以查看键的值:$ oc get configmaps game-config -o yaml

输出示例

apiVersion: v1 data: game.properties: |- enemies=aliens lives=3 enemies.cheat=true enemies.cheat.level=noGoodRotten secret.code.passphrase=UUDDLRLRBABAS secret.code.allowed=true secret.code.lives=30 ui.properties: | color.good=purple color.bad=yellow allow.textmode=true how.nice.to.look=fairlyNice kind: ConfigMap metadata: creationTimestamp: 2016-02-18T18:34:05Z name: game-config namespace: default resourceVersion: "407" selflink: /api/v1/namespaces/default/configmaps/game-config uid: 30944725-d66e-11e5-8cd0-68f728db1985

2.5.3.2. 从文件创建配置映射

您可以使用 --from-file 标志从文件创建配置映射。您可以多次将 --from-file 选项传递给 CLI。

您还可以通过将 key=value 表达式传递给 --from-file 选项,在配置映射中为从文件中导入的内容指定要设置的键。例如:

$ oc create configmap game-config-3 --from-file=game-special-key=example-files/game.properties

如果从文件创建一个配置映射,您可以在不会破坏非 UTF8 数据的项中包含非 UTF8 的数据。Red Hat OpenShift Service on AWS 会检测二进制文件,并透明地将文件编码为 MIME。在服务器上,MIME 有效负载被解码并存储而不会损坏数据。

前提条件

您必须有一个目录,其中包含您要使用填充配置映射的数据的文件。

以下流程使用这些示例文件:

game.properties和ui.properties:$ cat example-files/game.properties

输出示例

enemies=aliens lives=3 enemies.cheat=true enemies.cheat.level=noGoodRotten secret.code.passphrase=UUDDLRLRBABAS secret.code.allowed=true secret.code.lives=30

$ cat example-files/ui.properties

输出示例

color.good=purple color.bad=yellow allow.textmode=true how.nice.to.look=fairlyNice

流程

通过指定特定文件来创建配置映射:

$ oc create configmap game-config-2 \ --from-file=example-files/game.properties \ --from-file=example-files/ui.properties通过指定键值对来创建配置映射:

$ oc create configmap game-config-3 \ --from-file=game-special-key=example-files/game.properties

验证

使用

-o选项为对象输入oc get命令,以查看文件中的键值:$ oc get configmaps game-config-2 -o yaml

输出示例

apiVersion: v1 data: game.properties: |- enemies=aliens lives=3 enemies.cheat=true enemies.cheat.level=noGoodRotten secret.code.passphrase=UUDDLRLRBABAS secret.code.allowed=true secret.code.lives=30 ui.properties: | color.good=purple color.bad=yellow allow.textmode=true how.nice.to.look=fairlyNice kind: ConfigMap metadata: creationTimestamp: 2016-02-18T18:52:05Z name: game-config-2 namespace: default resourceVersion: "516" selflink: /api/v1/namespaces/default/configmaps/game-config-2 uid: b4952dc3-d670-11e5-8cd0-68f728db1985使用

-o选项为对象输入oc get命令,以查看键值对中的键值:$ oc get configmaps game-config-3 -o yaml

输出示例

apiVersion: v1 data: game-special-key: |- 1 enemies=aliens lives=3 enemies.cheat=true enemies.cheat.level=noGoodRotten secret.code.passphrase=UUDDLRLRBABAS secret.code.allowed=true secret.code.lives=30 kind: ConfigMap metadata: creationTimestamp: 2016-02-18T18:54:22Z name: game-config-3 namespace: default resourceVersion: "530" selflink: /api/v1/namespaces/default/configmaps/game-config-3 uid: 05f8da22-d671-11e5-8cd0-68f728db1985- 1

- 这是您在前面的步骤中设置的密钥。

2.5.3.3. 从字面值创建配置映射

您可以为配置映射提供字面值。

--from-literal 选项采用 key=value 语法,它允许直接在命令行中提供字面值。

流程

通过指定字面值来创建配置映射:

$ oc create configmap special-config \ --from-literal=special.how=very \ --from-literal=special.type=charm

验证

使用带有

-o选项的oc get命令以查看键的值:$ oc get configmaps special-config -o yaml

输出示例

apiVersion: v1 data: special.how: very special.type: charm kind: ConfigMap metadata: creationTimestamp: 2016-02-18T19:14:38Z name: special-config namespace: default resourceVersion: "651" selflink: /api/v1/namespaces/default/configmaps/special-config uid: dadce046-d673-11e5-8cd0-68f728db1985

2.5.4. 用例: 在 pod 中使用配置映射

以下小节描述了在 pod 中消耗 ConfigMap 对象时的一些用例。

2.5.4.1. 使用配置映射在容器中填充环境变量

您可以使用配置映射在容器中填充各个环境变量,或从构成有效环境变量名称的所有键填充容器中的环境变量。

例如,请考虑以下配置映射:

有两个环境变量的 ConfigMap

apiVersion: v1 kind: ConfigMap metadata: name: special-config 1 namespace: default 2 data: special.how: very 3 special.type: charm 4

带有一个环境变量的ConfigMap

apiVersion: v1 kind: ConfigMap metadata: name: env-config 1 namespace: default data: log_level: INFO 2

流程

您可以使用

configMapKeyRef部分在 pod 中使用此ConfigMap的键。配置为注入特定环境变量的

Pod规格示例apiVersion: v1 kind: Pod metadata: name: dapi-test-pod spec: securityContext: runAsNonRoot: true seccompProfile: type: RuntimeDefault containers: - name: test-container image: gcr.io/google_containers/busybox command: [ "/bin/sh", "-c", "env" ] env: 1 - name: SPECIAL_LEVEL_KEY 2 valueFrom: configMapKeyRef: name: special-config 3 key: special.how 4 - name: SPECIAL_TYPE_KEY valueFrom: configMapKeyRef: name: special-config 5 key: special.type 6 optional: true 7 envFrom: 8 - configMapRef: name: env-config 9 securityContext: allowPrivilegeEscalation: false capabilities: drop: [ALL] restartPolicy: Never当此 pod 运行时,pod 日志包括以下输出:

SPECIAL_LEVEL_KEY=very log_level=INFO

示例输出中没有列出 SPECIAL_TYPE_KEY=charm,因为设置了 optional: true。

2.5.4.2. 使用配置映射为容器命令设置命令行参数

您可以通过 Kubernetes 替换语法 $(VAR_NAME),使用配置映射来设置容器中的命令或参数的值。

例如,请考虑以下配置映射:

apiVersion: v1 kind: ConfigMap metadata: name: special-config namespace: default data: special.how: very special.type: charm

流程

要将值注入到容器中的一个命令中,使用您要用作环境变量的键。然后,您可以使用

$(VAR_NAME)语法在容器的命令中引用它们。配置为注入特定环境变量的 pod 规格示例

apiVersion: v1 kind: Pod metadata: name: dapi-test-pod spec: securityContext: runAsNonRoot: true seccompProfile: type: RuntimeDefault containers: - name: test-container image: gcr.io/google_containers/busybox command: [ "/bin/sh", "-c", "echo $(SPECIAL_LEVEL_KEY) $(SPECIAL_TYPE_KEY)" ] 1 env: - name: SPECIAL_LEVEL_KEY valueFrom: configMapKeyRef: name: special-config key: special.how - name: SPECIAL_TYPE_KEY valueFrom: configMapKeyRef: name: special-config key: special.type securityContext: allowPrivilegeEscalation: false capabilities: drop: [ALL] restartPolicy: Never- 1

- 使用您要用作环境变量的键将值注入到容器中的命令中。

当此 pod 运行时,test-container 容器中运行的 echo 命令的输出如下:

very charm

2.5.4.3. 使用配置映射将内容注入卷

您可以使用配置映射将内容注入卷。

ConfigMap 自定义资源(CR)示例

apiVersion: v1 kind: ConfigMap metadata: name: special-config namespace: default data: special.how: very special.type: charm

流程

您可以使用配置映射将内容注入卷中有两个不同的选项。

使用配置映射将内容注入卷的最基本方法是在卷中填充键为文件名称的文件,文件的内容是键值:

apiVersion: v1 kind: Pod metadata: name: dapi-test-pod spec: securityContext: runAsNonRoot: true seccompProfile: type: RuntimeDefault containers: - name: test-container image: gcr.io/google_containers/busybox command: [ "/bin/sh", "-c", "cat", "/etc/config/special.how" ] volumeMounts: - name: config-volume mountPath: /etc/config securityContext: allowPrivilegeEscalation: false capabilities: drop: [ALL] volumes: - name: config-volume configMap: name: special-config 1 restartPolicy: Never- 1

- 包含密钥的文件。

当这个 pod 运行时,cat 命令的输出将是:

very

您还可以控制投射配置映射键的卷中的路径:

apiVersion: v1 kind: Pod metadata: name: dapi-test-pod spec: securityContext: runAsNonRoot: true seccompProfile: type: RuntimeDefault containers: - name: test-container image: gcr.io/google_containers/busybox command: [ "/bin/sh", "-c", "cat", "/etc/config/path/to/special-key" ] volumeMounts: - name: config-volume mountPath: /etc/config securityContext: allowPrivilegeEscalation: false capabilities: drop: [ALL] volumes: - name: config-volume configMap: name: special-config items: - key: special.how path: path/to/special-key 1 restartPolicy: Never- 1

- 配置映射键的路径。

当这个 pod 运行时,cat 命令的输出将是:

very

2.6. 在 pod 调度决策中纳入 pod 优先级

您可以在集群中启用 pod 优先级与抢占功能。pod 优先级代表与其他 pod 相比此 pod 的重要性,并根据优先级进行队列处理。抢占(preemption)则允许集群驱除低优先级 pod 或与之争抢,从而在合适的节点上没有可用空间时能够调度优先级较高的 pod。pod 优先级也会影响 pod 的调度顺序以及节点上资源不足驱除顺序。

要使用优先级与抢占功能,引用 pod 规格中的优先级类,以应用该权重以进行调度。

2.6.1. 了解 pod 优先级

当您使用 pod 优先级与抢占功能时,调度程序会根据优先级来调度待处理 pod,而待处理 pod 会放在调度队列中优先级较低的其他待处理 pod 的前面。因此,如果达到调度要求,较高优先级的 pod 可能比低优先级的 pod 更早调度。如果 pod 无法调度,调度程序会继续调度其他较低优先级 pod。

2.6.1.1. Pod 优先级类

您可以为 pod 分配一个优先级类,它是一种非命名空间的对象,用于定义从名称到优先级整数值的映射。数值越大,优先级越高。

优先级类对象可以取小于或等于 1000000000(十亿)的 32 位整数值。对于不得被抢占或被驱除的关键 pod,请保留大于或等于 10 亿的数值。默认情况下,Red Hat OpenShift Service on AWS 有两个保留优先级类,用于关键系统 pod 有保证调度。

$ oc get priorityclasses

输出示例

NAME VALUE GLOBAL-DEFAULT AGE system-node-critical 2000001000 false 72m system-cluster-critical 2000000000 false 72m openshift-user-critical 1000000000 false 3d13h cluster-logging 1000000 false 29s

system-node-critical - 此优先级类的值为 2000001000,用于所有不得从节点上驱除的 pod。具有此优先级类的 pod 示例是

ovnkube-node等。许多关键组件默认包括system-node-critical优先级类,例如:- master-api

- master-controller

- master-etcd

- ovn-kubernetes

- sync

system-cluster-critical - 此优先级类的值是 2000000000(二十亿),用于对集群而言很重要的 pod。在某些情况下,具有此优先级类的 Pod 可以从节点中驱除。例如,配置了

system-node-critical优先级类的 pod 可以拥有优先权。不过,此优先级类确实能够保证调度。具有此优先级类的 pod 示例有 fluentd 以及 descheduler 这样的附加组件等。许多关键组件默认包括system-cluster-critical优先级类,例如:- fluentd

- metrics-server

- descheduler

-

openshift-user-critical - 您可以使用带有重要 pod 的

priorityClassName字段,这些 pod 无法绑定其资源消耗,且没有可预测的资源消耗行为。openshift-monitoring和openshift-user-workload-monitoring命名空间下的 Prometheus Pod 使用openshift-user-criticalpriorityClassName。监控工作负载使用system-critical作为其第一个priorityClass,但在监控使用过量内存时造成问题,且无法驱除它们。因此,监控会丢弃优先级,为调度程序带来灵活性,并围绕移动繁重的工作负载来保持关键节点正常操作。 - cluster-logging - 此优先级类供 Fluentd 用于确保 Fluentd pod 优先于其他应用调度到节点上。

2.6.1.2. Pod 优先级名称

拥有一个或多个优先级类后,您可以创建 pod,并在 Pod 规格中指定优先级类名称。优先准入控制器使用优先级类名称字段来填充优先级的整数值。如果没有找到给定名称的优先级类,pod 将被拒绝。

2.6.2. 了解 pod 抢占

当开发人员创建 pod 时,pod 会排入某一队列。如果开发人员为 pod 配置了 pod 优先级或抢占,调度程序会从队列中选取 pod,并尝试将 pod 调度到某个节点上。如果调度程序无法在满足 pod 的所有指定要求的适当节点上找到空间,则会为待处理 pod 触发抢占逻辑。

当调度程序在节点上抢占一个或多个 pod 时,较高优先级 Pod spec 的 nominatedNodeName 字段 将设为该节点的名称,nodename 字段也是如此。调度程序使用 nominatedNodeName 字段来跟踪为 pod 保留的资源,同时也向用户提供与集群中抢占相关的信息。

在调度程序抢占了某一较低优先级 pod 后,调度程序会尊重该 pod 的安全终止期限。如果在调度程序等待较低优先级 pod 终止过程中另一节点变为可用,调度程序会将较高优先级 pod 调度到该节点上。因此,Pod spec 的 nominatedNodeName 字段和 nodeName 字段可能会有所不同。

另外,如果调度程序在某一节点上抢占 pod 并正在等待终止,这时又有优先级比待处理 pod 高的 pod 需要调度,那么调度程序可以改为调度这个优先级更高的 pod。在这种情况下,调度程序会清除待处理 pod 的 nominatedNodeName,使该 pod 有资格调度到其他节点上。

抢占不一定从节点中移除所有较低优先级 pod。调度程序可以通过移除一部分较低优先级 pod 调度待处理 pod。

只有待处理 pod 能够调度到节点时,调度程序才会对这个节点考虑 pod 抢占。

2.6.2.1. 非抢占优先级类

抢占策略设置为 Never 的 Pod 会放置在较低优先级 pod 的调度队列中,但无法抢占其他 pod。等待调度的非抢占 pod 会保留在调度队列中,直到资源可用且可以调度。非抢占 pod 与其他 pod 一样,受调度程序后退避的影响。这意味着,如果调度程序尝试调度这些 pod,它们会以较低频率重试,允许在调度前调度其他优先级较低的 pod。

非抢占 pod 仍可被其他高优先级 pod 抢占。

2.6.2.2. Pod 抢占和其他调度程序设置

如果启用 pod 优先级与抢占功能,请考虑其他的调度程序设置:

- pod 优先级和 pod 中断预算

- pod 中断预算指定某一时间必须保持在线的副本的最小数量或百分比。如果您指定了 pod 中断预算,Red Hat OpenShift Service on AWS 会在抢占 pod 时考虑它们。调度程序会尝试在不违反 pod 中断预算的前提下抢占 pod。如果找不到这样的 pod,则可能会无视 pod 中断预算要求而抢占较低优先级 pod。

- pod 优先级和 pod 关联性

- pod 关联性要求将新 pod 调度到与具有同样标签的其他 pod 相同的节点上。

如果待处理 pod 与节点上的一个或多个低优先级 pod 具有 pod 间关联性,调度程序就不能在不违反关联要求的前提下抢占较低优先级 pod。这时,调度程序会寻找其他节点来调度待处理 pod。但是,不能保证调度程序能够找到合适的节点,因此可能无法调度待处理 pod。

要防止这种情况,请仔细配置优先级相同的 pod 的 pod 关联性。

2.6.2.3. 安全终止被抢占的 pod

在抢占 pod 时,调度程序会等待 pod 安全终止期限到期,使 pod 能够完成工作并退出。如果 pod 在到期后没有退出,调度程序会终止该 pod。此安全终止期限会在调度程序抢占该 pod 的时间和待处理 pod 调度到节点的时间之间造成一个时间差。

要尽量缩短这个时间差,可以为较低优先级 pod 配置较短的安全终止期限。

2.6.3. 配置优先级和抢占

您可以通过创建优先级类对象并使用 pod 规格中的 priorityClassName 将 pod 与优先级关联来应用 pod 优先级与抢占。

您不能直接将优先级类添加到现有调度的 pod 中。

流程

配置集群以使用优先级与抢占功能:

通过创建类似如下的 YAML 文件,定义 pod spec 使其包含优先级类的名称:

apiVersion: v1 kind: Pod metadata: name: nginx labels: env: test spec: containers: - name: nginx image: nginx imagePullPolicy: IfNotPresent priorityClassName: system-cluster-critical 1- 1

- 指定要用于此 pod 的优先级类。

创建 pod:

$ oc create -f <file-name>.yaml

您可以将优先级名称直接添加到 pod 配置或 pod 模板中。

2.7. 使用节点选择器将 pod 放置到特定节点

节点选择器指定一个键值对映射。使用节点中的自定义标签和 pod 中指定的选择器来定义规则。

若要使 pod 有资格在某一节点上运行,pod 必须具有指定为该节点上标签的键值对。

如果您在同一 pod 配置中同时使用节点关联性和节点选择器,请查看下方的重要注意事项。

2.7.1. 使用节点选择器控制 pod 放置

您可以使用节点上的 pod 和标签上的节点选择器来控制 pod 的调度位置。使用节点选择器时,Red Hat OpenShift Service on AWS 会将 pod 调度到包含匹配标签的节点。

您可向节点、计算机器集或机器配置添加标签。将标签添加到计算机器集可确保节点或机器停机时,新节点具有该标签。如果节点或机器停机,添加到节点或机器配置的标签不会保留。

要将节点选择器添加到现有 pod 中,将节点选择器添加到该 pod 的控制对象中,如 ReplicaSet 对象、DaemonSet 对象、StatefulSet 对象、Deployment 对象或 DeploymentConfig 对象。任何属于该控制对象的现有 pod 都会在具有匹配标签的节点上重新创建。如果要创建新 pod,可以将节点选择器直接添加到 pod 规格中。如果 pod 没有控制对象,您必须删除 pod,编辑 pod 规格并重新创建 pod。

您不能直接将节点选择器添加到现有调度的 pod 中。

先决条件

要将节点选择器添加到现有 pod 中,请确定该 pod 的控制对象。例如, router-default-66d5cf9464-m2g75 pod 由 router-default-66d5cf9464 副本集控制:

$ oc describe pod router-default-66d5cf9464-7pwkc

输出示例

kind: Pod apiVersion: v1 metadata: # ... Name: router-default-66d5cf9464-7pwkc Namespace: openshift-ingress # ... Controlled By: ReplicaSet/router-default-66d5cf9464 # ...

Web 控制台在 pod YAML 的 ownerReferences 下列出控制对象:

apiVersion: v1

kind: Pod

metadata:

name: router-default-66d5cf9464-7pwkc

# ...

ownerReferences:

- apiVersion: apps/v1

kind: ReplicaSet

name: router-default-66d5cf9464

uid: d81dd094-da26-11e9-a48a-128e7edf0312

controller: true

blockOwnerDeletion: true

# ...流程

将匹配的节点选择器添加到 pod:

要将节点选择器添加到现有和未来的 pod,请向 pod 的控制对象添加节点选择器:

带有标签的

ReplicaSet对象示例kind: ReplicaSet apiVersion: apps/v1 metadata: name: hello-node-6fbccf8d9 # ... spec: # ... template: metadata: creationTimestamp: null labels: ingresscontroller.operator.openshift.io/deployment-ingresscontroller: default pod-template-hash: 66d5cf9464 spec: nodeSelector: kubernetes.io/os: linux node-role.kubernetes.io/worker: '' type: user-node 1 # ...- 1

- 添加节点选择器。

要将节点选择器添加到一个特定的新 pod,直接将选择器添加到

Pod对象中:使用节点选择器的

Pod对象示例apiVersion: v1 kind: Pod metadata: name: hello-node-6fbccf8d9 # ... spec: nodeSelector: region: east type: user-node # ...注意您不能直接将节点选择器添加到现有调度的 pod 中。

第 3 章 使用自定义 Metrics Autoscaler Operator 自动扩展 pod

3.1. 发行注记

3.1.1. 自定义 Metrics Autoscaler Operator 发行注记

Red Hat OpenShift 的自定义 Metrics Autoscaler Operator 发行注记介绍了新的功能和增强功能、已弃用的功能以及已知的问题。

Custom Metrics Autoscaler Operator 使用基于 Kubernetes 的 Event Driven Autoscaler (KEDA),并基于 Red Hat OpenShift Service on AWS 横向自动扩展(HPA)构建。

Custom Metrics Autoscaler Operator for Red Hat OpenShift 作为可安装的组件提供,它与 Red Hat OpenShift Service on AWS 核心不同。Red Hat OpenShift Container Platform 生命周期政策概述了发行版本兼容性。

3.1.1.1. 支持的版本

下表为每个 Red Hat OpenShift Service on AWS 版本定义自定义 Metrics Autoscaler Operator 版本。

| Version | Red Hat OpenShift Service on AWS 版本 | 公开发行(GA) |

|---|---|---|

| 2.14.1 | 4.16 | 公开发行(GA) |

| 2.14.1 | 4.15 | 公开发行(GA) |

| 2.14.1 | 4.14 | 公开发行(GA) |

| 2.14.1 | 4.13 | 公开发行(GA) |

| 2.14.1 | 4.12 | 公开发行(GA) |

3.1.1.2. 自定义 Metrics Autoscaler Operator 2.14.1-467 发行注记

此自定义 Metrics Autoscaler Operator 2.14.1-467 发行版本为在 Red Hat OpenShift Service on AWS 集群中运行 Operator 提供了 CVE 和程序错误修复。以下公告可用于 RHSA-2024:7348。

在安装此版本的 Custom Metrics Autoscaler Operator 之前,请删除任何以前安装的技术预览版本或基于 Kubernetes 的社区支持的 Event Driven Autoscaler (KEDA)。

3.1.1.2.1. 程序错误修复

- 在以前的版本中,自定义 Metrics Autoscaler Operator pod 的 root 文件系统是可写的,这并不是必需的,并可能会造成安全问题。在这个版本中,pod root 文件系统为只读方式,解决了潜在的安全问题。(OCPBUGS-37989)

3.1.2. Custom Metrics Autoscaler Operator 的过去发行版本发行注记

以下发行注记适用于以前的自定义 Metrics Autoscaler Operator 版本。

有关当前版本,请参阅自定义 Metrics Autoscaler Operator 发行注记。

3.1.2.1. 自定义 Metrics Autoscaler Operator 2.14.1-454 发行注记

此自定义 Metrics Autoscaler Operator 2.14.1-454 发行版本为在 Red Hat OpenShift Service on AWS 集群中运行 Operator 提供了 CVE、新功能和程序错误修复。以下公告可用于 RHBA-2024:5865。

在安装此版本的 Custom Metrics Autoscaler Operator 之前,请删除任何以前安装的技术预览版本或基于 Kubernetes 的社区支持的 Event Driven Autoscaler (KEDA)。

3.1.2.1.1. 新功能及功能增强

3.1.2.1.1.1. 支持带有自定义 Metrics Autoscaler Operator 的 Cron 触发器

Custom Metrics Autoscaler Operator 现在可以使用 Cron trigger,根据每个小时的调度来扩展 pod。当您指定的时间段启动时,Custom Metrics Autoscaler Operator 会将 pod 扩展至所需数量。当时间段结束时,Operator 会缩减到以前的级别。

如需更多信息,请参阅了解 Cron 触发器。

3.1.2.1.2. 程序错误修复

-

在以前的版本中,如果您更改了

KedaController自定义资源中的审计配置参数,则keda-metrics-server-audit-policy配置映射不会被更新。因此,在自定义 Metrics Autoscaler 初始部署后,您无法更改审计配置参数。在这个版本中,对审计配置的更改现在可以在配置映射中正确显示,允许您在安装后随时更改审计配置。(OCPBUGS-32521)

3.1.2.2. Custom Metrics Autoscaler Operator 2.13.1 发行注记

此自定义 Metrics Autoscaler Operator 2.13.1-421 发行版本提供了一个新功能,并在 Red Hat OpenShift Service on AWS 集群中运行 Operator。以下公告可用于 RHBA-2024:4837。

在安装此版本的 Custom Metrics Autoscaler Operator 之前,请删除任何以前安装的技术预览版本或基于 Kubernetes 的社区支持的 Event Driven Autoscaler (KEDA)。

3.1.2.2.1. 新功能及功能增强

3.1.2.2.1.1. 支持使用自定义证书的 Custom Metrics Autoscaler Operator

Custom Metrics Autoscaler Operator 现在可以使用自定义服务 CA 证书安全地连接到启用了 TLS 的指标源,如外部 Kafka 集群或外部 Prometheus 服务。默认情况下,Operator 仅使用自动生成的服务证书来连接到 on-cluster 服务。KedaController 对象中有一个新字段,您可以使用配置映射载入自定义服务器 CA 证书以连接到外部服务。

如需更多信息,请参阅 Custom Metrics Autoscaler 的自定义 CA 证书。

3.1.2.2.2. 程序错误修复

-

在以前的版本中,

custom-metrics-autoscaler和custom-metrics-autoscaler-adapter镜像缺少时区信息。因此,带有cron触发器的扩展对象无法正常工作,因为控制器无法找到时区信息。在这个版本中,镜像构建被更新为包含时区信息。因此,包含cron触发器的对象现在可以正常工作。Custom Metrics Autoscaler 目前不支持包含cron触发器的扩展对象。(OCPBUGS-34018)

3.1.2.3. 自定义 Metrics Autoscaler Operator 2.12.1-394 发行注记

此自定义 Metrics Autoscaler Operator 2.12.1-394 发行版本为在 Red Hat OpenShift Service on AWS 集群中运行 Operator 提供了程序错误修复。以下公告可用于 RHSA-2024:2901。

在安装此版本的 Custom Metrics Autoscaler Operator 之前,请删除任何以前安装的技术预览版本或基于 Kubernetes 的社区支持的 Event Driven Autoscaler (KEDA)。

3.1.2.3.1. 程序错误修复

-

在以前的版本中,当对无效 JSON 的特定表单进行 unmarshaling 处理时,

protojson.Unmarshal函数会进入一个死循环。当 unmarshaling 到包含google.protobuf.Any值或设置了UnmarshalOptions.DiscardUnknown选项时,可能会出现此条件。此发行版本解决了这个问题。(OCPBUGS-30305) -

在以前的版本中,当解析多部分表单时,可以明确使用

Request.ParseMultipartForm方法明,或使用Request.FormValue、Request.PostFormValue或Request.FormFile方法隐式应用,解析表单的总大小限制不适用于消耗的内存。这可能导致内存耗尽。在这个版本中,解析过程可以正确地限制最大大小。(OCPBUGS-30360) -

在以前的版本中,当遵循 HTTP 重定向到不在匹配子域或初始域的完全匹配的域时,HTTP 客户端不会转发敏感标头,如

Authorization或Cookie。例如,从example.com到www.example.com的重定向会转发Authorization标头,但重定向到www.example.org不会转发标头。此发行版本解决了这个问题。(OCPBUGS-30365) -

在以前的版本中,验证包含带有未知公钥算法的证书的证书链会导致证书验证过程 panic。此条件会影响将

Config.ClientAuth参数设置为VerifyClientCertIfGiven或RequireAndVerifyClientCert值的所有加密和 Transport Layer Security (TLS) 客户端和服务器。默认行为是 TLS 服务器无法验证客户端证书。此发行版本解决了这个问题。(OCPBUGS-30370) -

在以前的版本中,如果从

MarshalJSON方法返回的错误包含用户控制的数据,攻击者可以使用数据中断 HTML 模板软件包的上下文自动转义行为。此条件允许后续操作将意外内容注入模板。此发行版本解决了这个问题。(OCPBUGS-30397) -

在以前的版本中,

net/http和golang.org/x/net/http2Go 软件包没有限制为 HTTP/2 请求读取的CONTINUATION帧的数量。这个条件可能会导致过量消耗 CPU。此发行版本解决了这个问题。(OCPBUGS-30894)

3.1.2.4. 自定义 Metrics Autoscaler Operator 2.12.1-384 发行注记

此自定义 Metrics Autoscaler Operator 2.12.1-384 发行版本为在 Red Hat OpenShift Service on AWS 集群中运行的 Operator 提供了程序错误修复。以下公告可用于 RHBA-2024:2043。

在安装自定义 Metrics Autoscaler Operator 的这个版本前,请删除任何以前安装的技术预览版本或社区支持的 KEDA 版本。

3.1.2.4.1. 程序错误修复

-

在以前的版本中,

custom-metrics-autoscaler和custom-metrics-autoscaler-adapter镜像缺少时区信息。因此,带有cron触发器的扩展对象无法正常工作,因为控制器无法找到时区信息。在这个版本中,镜像构建被更新为包含时区信息。因此,包含cron触发器的对象现在可以正常工作。(OCPBUGS-32395)

3.1.2.5. 自定义 Metrics Autoscaler Operator 2.12.1-376 发行注记

此自定义 Metrics Autoscaler Operator 2.12.1-376 发行版本为在 Red Hat OpenShift Service on AWS 集群中运行的 Operator 提供安全更新和程序错误修复。以下公告可用于 RHSA-2024:1812。

在安装自定义 Metrics Autoscaler Operator 的这个版本前,请删除任何以前安装的技术预览版本或社区支持的 KEDA 版本。

3.1.2.5.1. 程序错误修复

- 在以前的版本中,如果在扩展对象元数据中指定无效值,如不存在的命名空间,则底层 scaler 客户端无法释放或关闭其客户端描述符,从而导致内存泄漏。在这个版本中,当出现错误时可以正确地关闭底层客户端描述符,从而导致内存泄漏。(OCPBUGS-30145)

-

在以前的版本中,

keda-metrics-apiserverpod 的ServiceMonitor自定义资源 (CR) 无法正常工作,因为 CR 引用了http的错误指标端口名称。在这个版本中,ServiceMonitorCR 修正了引用metrics的正确端口名称。因此,Service Monitor 可以正常工作。(OCPBUGS-25806)

3.1.2.6. 自定义 Metrics Autoscaler Operator 2.11.2-322 发行注记

此自定义 Metrics Autoscaler Operator 2.11.2-322 发行版本为在 Red Hat OpenShift Service on AWS 集群中运行 Operator 提供了安全更新和程序错误修复。以下公告可用于 RHSA-2023:6144。

在安装自定义 Metrics Autoscaler Operator 的这个版本前,请删除任何以前安装的技术预览版本或社区支持的 KEDA 版本。

3.1.2.6.1. 程序错误修复

- 因为自定义 Metrics Autoscaler Operator 版本 3.11.2-311 已被发布,所以在 Operator 部署中不需要卷挂载,所以自定义 Metrics Autoscaler Operator pod 会每 15 分钟重启。在这个版本中,在 Operator 部署中添加了所需的卷挂载。因此,Operator 不再每 15 分钟重启。(OCPBUGS-22361)

3.1.2.7. 自定义 Metrics Autoscaler Operator 2.11.2-311 发行注记

此自定义 Metrics Autoscaler Operator 2.11.2-311 发行版本为在 Red Hat OpenShift Service on AWS 集群中运行 Operator 提供了新功能和程序错误修复。自定义 Metrics Autoscaler Operator 2.11.2-311 的组件在 RHBA-2023:5981 中发布。

在安装自定义 Metrics Autoscaler Operator 的这个版本前,请删除任何以前安装的技术预览版本或社区支持的 KEDA 版本。

3.1.2.7.1. 新功能及功能增强

3.1.2.7.1.1. 现在支持 Red Hat OpenShift Service on AWS (ROSA) 和 OpenShift Dedicated

自定义 Metrics Autoscaler Operator 2.11.2-311 可以安装在 OpenShift ROSA 和 OpenShift Dedicated 受管集群上。自定义 Metrics Autoscaler Operator 的早期版本只能安装在 openshift-keda 命名空间中。这导致 Operator 无法安装到 OpenShift ROSA 和 OpenShift Dedicated 集群中。此自定义 Metrics Autoscaler 版本允许安装到其他命名空间,如 openshift-operators 或 keda,从而可以安装到 ROSA 和 Dedicated 集群中。

3.1.2.7.2. 程序错误修复

-

在以前的版本中,如果安装并配置 Custom Metrics Autoscaler Operator,但没有使用,OpenShift CLI 会在任何

oc命令输入后报告could not get resource list for external.metrics.k8s.io/v1beta1: Got empty response for: external.metrics.k8s.io/v1beta1错误。虽然这个消息并没有什么危害,但可能会造成混淆。在这个版本中,Got empty response for: external.metrics…不再会出现。(OCPBUGS-15779) - 在以前的版本中,任何注解或标签更改为由自定义 Metrics Autoscaler 管理的对象在修改 Keda Controller 时(例如在配置更改后)会被自定义 Metrics Autoscaler 恢复。这会导致对象中的标签持续更改。自定义 Metrics Autoscaler 现在使用自己的注解来管理标签和注解,注解或标签不再被错误地恢复。(OCPBUGS-15590)

3.1.2.8. 自定义 Metrics Autoscaler Operator 2.10.1-267 发行注记

此自定义 Metrics Autoscaler Operator 2.10.1-267 发行版本为在 Red Hat OpenShift Service on AWS 集群中运行 Operator 提供了新功能和程序错误修复。自定义 Metrics Autoscaler Operator 2.10.1-267 组件在 RHBA-2023:4089 中发布。

在安装自定义 Metrics Autoscaler Operator 的这个版本前,请删除任何以前安装的技术预览版本或社区支持的 KEDA 版本。

3.1.2.8.1. 程序错误修复

-

在以前的版本中,

custom-metrics-autoscaler和custom-metrics-autoscaler-adapter镜像不包含时区信息。因此,带有 cron 触发器的扩展对象无法正常工作,因为控制器无法找到时区信息。在这个版本中,镜像构建包含时区信息。因此,包含 cron 触发器的对象现在可以正常工作。(OCPBUGS-15264) -

在以前的版本中,自定义 Metrics Autoscaler Operator 会尝试拥有所有受管对象,包括其他命名空间中的对象和集群范围的对象。因此,自定义 Metrics Autoscaler Operator 无法创建角色绑定来读取 API 服务器所需的凭证。这会导致

kube-system命名空间中出现错误。在这个版本中,自定义 Metrics Autoscaler Operator 会跳过将ownerReference字段添加到另一个命名空间中的任何对象或任何集群范围的对象。现在,角色绑定会被创建,且没有任何错误。(OCPBUGS-15038) -

在以前的版本中,自定义 Metrics Autoscaler Operator 将

ownerReferences字段添加到openshift-keda命名空间中。虽然这不会造成功能问题,但存在此字段可能会给集群管理员造成混淆。在这个版本中,自定义 Metrics Autoscaler Operator 不会将ownerReference字段添加到openshift-keda命名空间中。因此,openshift-keda命名空间不再有一个 superfluousownerReference字段。(OCPBUGS-15293) -

在以前的版本中,如果您使用使用 pod 身份以外的身份验证方法配置的 Prometheus 触发器,并且

podIdentity参数设置为none,则触发器将无法扩展。在这个版本中,OpenShift 的自定义 Metrics Autoscaler 可以正确地处理nonepod 身份提供程序类型。因此,使用 pod 身份以外的身份验证方法配置的 Prometheus 触发器,其podIdentity参数设置为none现在可以正确扩展。(OCPBUGS-15274)

3.1.2.9. 自定义 Metrics Autoscaler Operator 2.10.1 发行注记

此自定义 Metrics Autoscaler Operator 2.10.1 发行版本为在 Red Hat OpenShift Service on AWS 集群中运行的 Operator 提供了新功能和程序错误修复。自定义 Metrics Autoscaler Operator 2.10.1 的组件在 RHEA-2023:3199 中发布。

在安装自定义 Metrics Autoscaler Operator 的这个版本前,请删除任何以前安装的技术预览版本或社区支持的 KEDA 版本。

3.1.2.9.1. 新功能及功能增强

3.1.2.9.1.1. 自定义 Metrics Autoscaler Operator 正式发布

现在,自定义 Metrics Autoscaler Operator 从自定义 Metrics Autoscaler Operator 版本 2.10.1 开始正式发布。

使用扩展作业进行扩展只是一个技术预览功能。技术预览功能不受红帽产品服务等级协议(SLA)支持,且功能可能并不完整。红帽不推荐在生产环境中使用它们。这些技术预览功能可以使用户提早试用新的功能,并有机会在开发阶段提供反馈意见。

有关红帽技术预览功能支持范围的更多信息,请参阅技术预览功能支持范围。

3.1.2.9.1.2. 性能指标

现在,您可以使用 Prometheus Query Language (PromQL) 查询自定义 Metrics Autoscaler Operator 的指标。

3.1.2.9.1.3. 暂停扩展对象的自定义指标自动扩展

现在,您可以根据需要暂停扩展对象的自动扩展,并在就绪时恢复自动扩展。

3.1.2.9.1.4. 副本回退到扩展的对象

现在,如果扩展对象无法从源获取指标,您可以指定要回退到的副本数。

3.1.2.9.1.5. 为扩展对象自定义 HPA 命名

现在,您可以在扩展的对象中为 pod 横向自动扩展指定自定义名称。

3.1.2.9.1.6. 激活和扩展阈值

因为 pod 横向自动扩展 (HPA) 无法扩展到 0 个副本或从 0 个副本进行扩展,所以在 HPA 执行缩放后,自定义 Metrics Autoscaler Operator 会进行该扩展。现在,您可以根据副本数指定 HPA 接管自动扩展的时间。这可以提高扩展策略的灵活性。

3.1.2.10. 自定义 Metrics Autoscaler Operator 2.8.2-174 发行注记

此自定义 Metrics Autoscaler Operator 2.8.2-174 发行版本为在 Red Hat OpenShift Service on AWS 集群中运行 Operator 提供了新功能和程序错误修复。Custom Metrics Autoscaler Operator 2.8.2-174 组件在 RHEA-2023:1683 中发布。

自定义 Metrics Autoscaler Operator 版本 2.8.2-174 是一个技术预览功能。

3.1.2.10.1. 新功能及功能增强

3.1.2.10.1.1. Operator 升级支持

现在,您可以从 Custom Metrics Autoscaler Operator 的早期版本升级。有关升级 Operator 的信息,请参阅"添加资源"中的"删除 Operator 更新频道"。

3.1.2.10.1.2. must-gather 支持

现在,您可以使用 Red Hat OpenShift Service on AWS must-gather 工具收集有关自定义 Metrics Autoscaler Operator 及其组件的数据。目前,使用带有自定义 Metrics Autoscaler 的 must-gather 工具的过程与其他 Operator 不同。如需更多信息,请参阅"添加资源"中的调试数据。

3.1.2.11. 自定义 Metrics Autoscaler Operator 2.8.2 发行注记

此自定义 Metrics Autoscaler Operator 2.8.2 发行版本为在 Red Hat OpenShift Service on AWS 集群中运行的 Operator 提供了新功能和程序错误修复。自定义 Metrics Autoscaler Operator 2.8.2 组件在 RHSA-2023:1042 中发布。

自定义 Metrics Autoscaler Operator 版本 2.8.2 是一个技术预览功能。

3.1.2.11.1. 新功能及功能增强

3.1.2.11.1.1. 审计日志记录

现在,您可以收集并查看自定义 Metrics Autoscaler Operator 及其相关组件的审计日志。审计日志是安全相关的按时间排序的记录,记录各个用户、管理员或其他系统组件影响系统的一系列活动。

3.1.2.11.1.2. 基于 Apache Kafka 指标扩展应用程序

现在,您可以使用 KEDA Apache kafka 触发器/scaler 根据 Apache Kafka 主题扩展部署。

3.1.2.11.1.3. 根据 CPU 指标扩展应用程序

现在,您可以使用 KEDA CPU 触发器/scaler 根据 CPU 指标扩展部署。

3.1.2.11.1.4. 根据内存指标扩展应用程序

现在,您可以使用 KEDA 内存触发器/scaler 根据内存指标扩展部署。

3.2. 自定义 Metrics Autoscaler Operator 概述

作为开发者,您可以使用 Custom Metrics Autoscaler Operator for Red Hat OpenShift 指定 Red Hat OpenShift Service on AWS 如何根据不基于 CPU 或内存的自定义指标自动增加或减少部署、有状态集、自定义资源或作业的数量。

Custom Metrics Autoscaler Operator 是一个基于 Kubernetes Event Driven Autoscaler (KEDA) 的可选 Operator,允许使用 pod 指标以外的其他指标源扩展工作负载。

自定义指标自动扩展目前仅支持 Prometheus、CPU、内存和 Apache Kafka 指标。

Custom Metrics Autoscaler Operator 根据特定应用程序的自定义外部指标扩展 pod。您的其他应用程序继续使用其他扩展方法。您可以配置 触发器 (也称为 scaler),这是自定义指标自动扩展器用来决定如何扩展的事件和指标的来源。自定义指标自动扩展使用 metrics API 将外部指标转换为 Red Hat OpenShift Service on AWS 可以使用的形式。自定义指标自动扩展会创建一个执行实际缩放的 pod 横向自动扩展(HPA)。

要使用自定义指标自动扩展,您可以为工作负载创建一个 ScaledObject 或 ScaledJob 对象,这是定义扩展元数据的自定义资源(CR)。您可以指定要缩放的部署或作业、要缩放的指标源 (trigger) 以及其他参数,如允许的最小和最大副本数。

您只能为每个您要扩展的工作负载创建一个扩展对象或扩展作业。另外,您不能在同一工作负载中使用扩展的对象或扩展作业以及 pod 横向自动扩展 (HPA)。

自定义指标自动扩展与 HPA 不同,可以缩减为零。如果将自定义指标自动扩展 CR 中的 minReplicaCount 值设置为 0,自定义指标自动扩展会将工作负载从 1 缩减到 0 个副本或从 0 个副本扩展到 1。这称为 激活阶段。扩展至 1 个副本后,HPA 会控制扩展。这称为 扩展阶段。

某些触发器允许您更改由集群指标自动扩展扩展的副本数量。在所有情况下,配置激活阶段的参数始终使用相同的短语,前缀为 激活。例如,如果 threshold 参数配置缩放,则 activationThreshold 将配置激活。通过配置激活和扩展阶段,您可以提高扩展策略的灵活性。例如,您可以配置更高的激活阶段,以便在指标特别低时防止扩展或缩减。

当每个决策不同时,激活值的优先级高于扩展值。例如,如果 threshold 被设置为 10,并且 activationThreshold 为 50,如果指标报告 40,则缩放器不会激活,并且 pod 缩减为零,即使 HPA 需要 4 个实例。

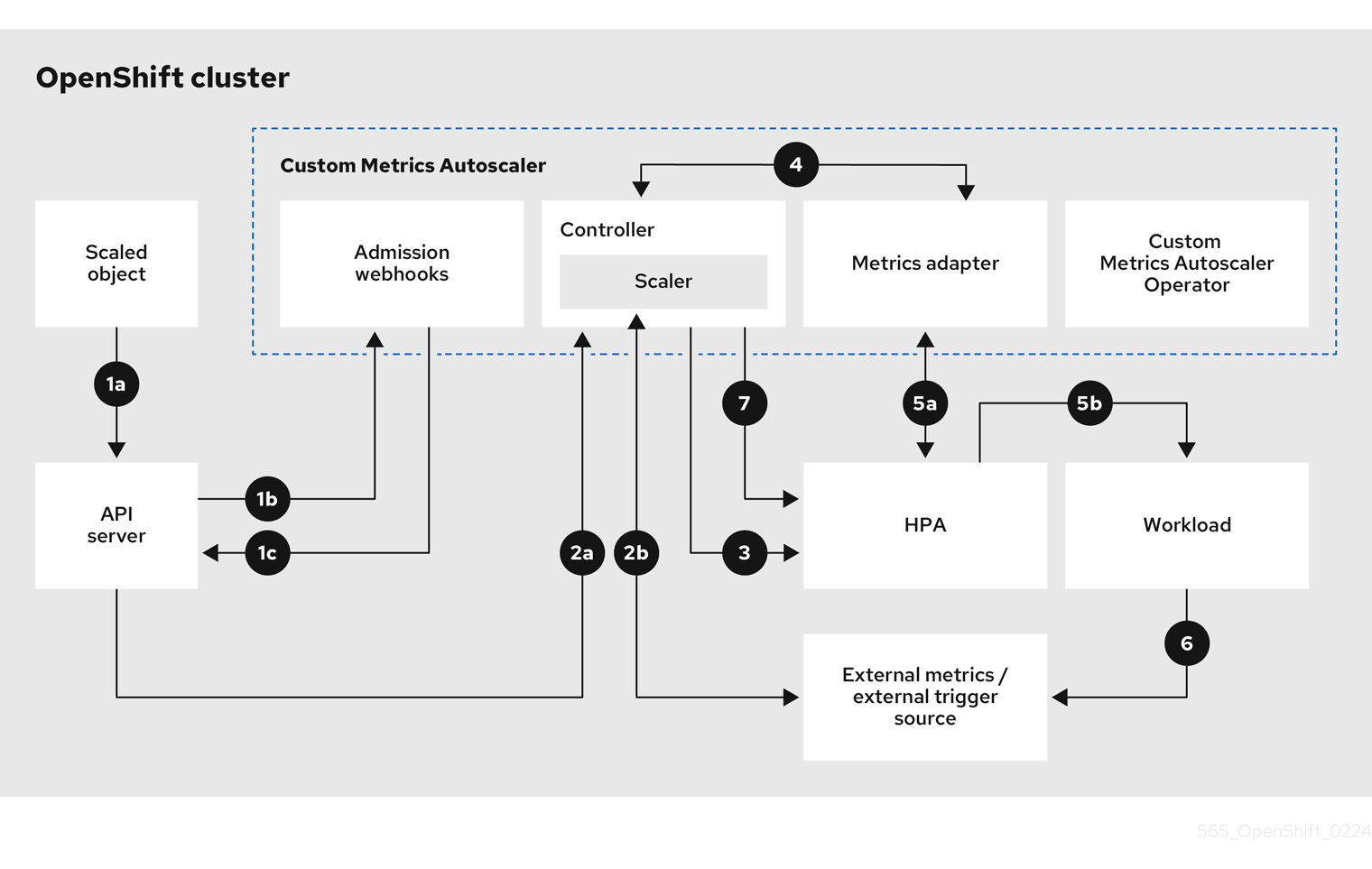

图 3.1. 自定义指标自动扩展工作流

- 您可以为集群中的工作负载创建或修改扩展对象自定义资源。对象包含该工作负载的扩展配置。在接受新对象前,OpenShift API 服务器将其发送到自定义指标自动扩展准入 webhook 进程,以确保对象有效。如果验证成功,API 服务器会保留对象。

- 自定义指标自动扩展控制器监视是否有新的或修改的扩展对象。当 OpenShift API 服务器通知更改控制器时,控制器会监控任何外部触发器源(也称为数据源)在对象中指定以更改指标数据。一个或多个 scalers 请求从外部触发器源扩展数据。例如,对于 Kafka 触发器类型,控制器使用 Kafka scaler 与 Kafka 实例通信来获取触发器请求的数据。

- 控制器为扩展的对象创建一个 pod 横向自动扩展对象。因此,Horizontal Pod Autoscaler (HPA) Operator 开始监控与触发器关联的扩展数据。HPA 请求从集群 OpenShift API 服务器端点扩展数据。

- OpenShift API 服务器端点由自定义指标自动扩展指标适配器提供。当 metrics 适配器收到自定义指标的请求时,它使用 GRPC 连接控制器来请求它以获取从 scaler 接收的最新触发器数据。

- HPA 根据从 metrics adapter 接收的数据做出缩放决策,并通过增加或减少副本来扩展工作负载。

- 当它运行时,工作负载可能会影响扩展指标。例如,如果扩展工作负载以处理 Kafka 队列中的工作,则队列大小会在工作负载处理所有工作后减小。因此,工作负载会缩减。

-

如果指标位于

minReplicaCount值指定的范围内,自定义指标自动扩展控制器会禁用所有扩展,并将副本数保留为固定级别。如果指标超过该范围,自定义指标自动扩展控制器将启用扩展并允许 HPA 扩展工作负载。当禁用扩展时,HPA 不会执行任何操作。

3.2.1. Custom Metrics Autoscaler 的自定义 CA 证书

默认情况下,自定义 Metrics Autoscaler Operator 使用自动生成的服务 CA 证书连接到 on-cluster 服务。

如果要使用需要自定义 CA 证书的非集群服务,您可以将所需的证书添加到配置映射中。然后,将配置映射添加到 KedaController 自定义资源,如安装自定义指标自动扩展中所述。Operator 在启动时加载这些证书,并将其注册为 Operator 信任的证书。

配置映射可以包含一个或多个包含一个或多个 PEM 编码 CA 证书的证书文件。或者,您可以为每个证书文件使用单独的配置映射。

如果稍后更新配置映射以添加额外的证书,您必须重启 keda-operator-* pod 以使更改生效。

3.3. 安装自定义指标自动扩展

您可以使用 Red Hat OpenShift Service on AWS Web 控制台安装自定义 Metrics Autoscaler Operator。

安装会创建以下五个 CRD:

-

ClusterTriggerAuthentication -

KedaController -

ScaledJob -

ScaledObject -

TriggerAuthentication

3.3.1. 安装自定义指标自动扩展

您可以使用以下步骤安装自定义 Metrics Autoscaler Operator。

先决条件

-

您可以使用具有

cluster-admin角色的用户访问集群。 - 删除之前安装的 Cluster Metrics Autoscaler Operator 的技术预览版本。

删除基于社区的 KEDA 的任何版本。

另外,运行以下命令来删除 KEDA 1.x 自定义资源定义:

$ oc delete crd scaledobjects.keda.k8s.io

$ oc delete crd triggerauthentications.keda.k8s.io

-

确保

keda命名空间存在。如果没有,则必须安全地创建keda命名空间。 可选:如果您需要自定义 Metrics Autoscaler Operator 连接到非集群服务,如外部 Kafka 集群或外部 Prometheus 服务,请将任何所需的服务 CA 证书放在配置映射中。配置映射必须存在于安装 Operator 的同一命名空间中。例如:

$ oc create configmap -n openshift-keda thanos-cert --from-file=ca-cert.pem

流程

- 在 Red Hat OpenShift Service on AWS web 控制台中,点 Operators → OperatorHub。

- 从可用的 Operator 列表中选择 Custom Metrics Autoscaler,然后点 Install。

- 在 Install Operator 页面中,确保为 Installation Mode 选择了 A specific namespace on the cluster 选项。

- 对于 Installed Namespace,点 Select a namespace。

点 Select Project:

-

如果存在

keda命名空间,请从列表中选择 keda。 如果

keda命名空间不存在:- 选择 Create Project 以打开 Create Project 窗口。

-

在 Name 字段中输入

keda。 -

在 Display Name 字段中输入描述性名称,如

keda。 - 可选:在 Display Name 字段中,为命名空间添加描述。

- 点 Create。

-

如果存在

- 点 Install。

列出自定义 Metrics Autoscaler Operator 组件来验证安装:

- 导航到 Workloads → Pods。

-

从下拉菜单中选择

keda项目,并验证custom-metrics-autoscaler-operatorautoscaler pod 是否正在运行。 -

进入到 Workloads → Deployments 以验证

custom-metrics-autoscaler-operator部署是否正在运行。

可选:使用以下命令在 OpenShift CLI 中验证安装:

$ oc get all -n keda

输出结果类似如下:

输出示例

NAME READY STATUS RESTARTS AGE pod/custom-metrics-autoscaler-operator-5fd8d9ffd8-xt4xp 1/1 Running 0 18m NAME READY UP-TO-DATE AVAILABLE AGE deployment.apps/custom-metrics-autoscaler-operator 1/1 1 1 18m NAME DESIRED CURRENT READY AGE replicaset.apps/custom-metrics-autoscaler-operator-5fd8d9ffd8 1 1 1 18m

安装

KedaController自定义资源,该资源创建所需的 CRD:- 在 Red Hat OpenShift Service on AWS web 控制台中,点 Operators → Installed Operators。

- 点 Custom Metrics Autoscaler。

- 在 Operator Details 页面中,点 KedaController 选项卡。

在 KedaController 选项卡中,点 Create KedaController 并编辑文件。

kind: KedaController apiVersion: keda.sh/v1alpha1 metadata: name: keda namespace: keda spec: watchNamespace: '' 1 operator: logLevel: info 2 logEncoder: console 3 caConfigMaps: 4 - thanos-cert - kafka-cert metricsServer: logLevel: '0' 5 auditConfig: 6 logFormat: "json" logOutputVolumeClaim: "persistentVolumeClaimName" policy: rules: - level: Metadata omitStages: ["RequestReceived"] omitManagedFields: false lifetime: maxAge: "2" maxBackup: "1" maxSize: "50" serviceAccount: {}

- 1

- 指定自定义 Metrics Autoscaler Operator 应该在其中扩展应用程序的单个命名空间。将它留空,或将其留空,以便在所有命名空间中扩展应用程序。此字段应具有命名空间或为空。默认值为空。

- 2

- 指定自定义 Metrics Autoscaler Operator 日志消息的详细程度。允许的值有

debug、info和error。默认为info。 - 3

- 指定 Custom Metrics Autoscaler Operator 日志消息的日志记录格式。允许的值是

console或json。默认为console。 - 4

- 可选:使用 CA 证书指定一个或多个配置映射,自定义 Metrics Autoscaler Operator 可以使用它们安全地连接到启用了 TLS 的指标源。

- 5

- 指定自定义 Metrics Autoscaler Metrics 服务器的日志记录级别。允许的值是

0(用于info)和4(用于debug)。默认值为0。 - 6

- 激活自定义 Metrics Autoscaler Operator 的审计日志记录,并指定要使用的审计策略,如"配置审计日志记录"部分中所述。

- 点 Create 创建 KEDA 控制器。

3.4. 了解自定义指标自动扩展触发器

触发器(也称为 scalers)提供自定义 Metrics Autoscaler Operator 用来扩展 pod 的指标。

自定义指标自动扩展目前只支持 Prometheus、CPU、内存和 Apache Kafka 触发器。

您可以使用 ScaledObject 或 ScaledJob 自定义资源为特定对象配置触发器,如后面的章节中所述。

您可以配置一个证书颁发机构与扩展对象一起使用,或配置为集群中的所有扩展程序。

3.4.1. 了解 Prometheus 触发器

您可以基于 Prometheus 指标扩展 pod,该指标可以使用已安装的 Red Hat OpenShift Service on AWS 监控或外部 Prometheus 服务器作为指标源。如需有关使用 Red Hat OpenShift Service on AWS 监控所需的配置作为指标源的信息,请参阅"配置自定义指标自动扩展以使用 Red Hat OpenShift Service on AWS 监控"。

如果 Prometheus 从自定义指标自动扩展扩展的应用程序收集指标,请不要在自定义资源中将最小副本设置为 0。如果没有应用程序 pod,自定义指标自动扩展没有任何要缩放的指标。

带有 Prometheus 目标的扩展对象示例

apiVersion: keda.sh/v1alpha1 kind: ScaledObject metadata: name: prom-scaledobject namespace: my-namespace spec: # ... triggers: - type: prometheus 1 metadata: serverAddress: https://thanos-querier.openshift-monitoring.svc.cluster.local:9092 2 namespace: kedatest 3 metricName: http_requests_total 4 threshold: '5' 5 query: sum(rate(http_requests_total{job="test-app"}[1m])) 6 authModes: basic 7 cortexOrgID: my-org 8 ignoreNullValues: "false" 9 unsafeSsl: "false" 10

- 1

- 指定 Prometheus 作为触发器类型。

- 2

- 指定 Prometheus 服务器的地址。本例使用 Red Hat OpenShift Service on AWS 监控。

- 3

- 可选:指定您要缩放的对象的命名空间。如果使用 Red Hat OpenShift Service on AWS 监控作为指标的源,则需要此参数。

- 4

- 指定在

external.metrics.k8s.ioAPI 中标识指标的名称。如果您使用的是多个触发器,则所有指标名称都必须是唯一的。 - 5

- 指定触发扩展的值。必须指定为带引号的字符串值。

- 6

- 指定要使用的 Prometheus 查询。

- 7

- 指定要使用的身份验证方法。Prometheus scalers 支持 bearer 身份验证 (

bearer)、基本身份验证 (basic) 或 TLS 身份验证 (tls)。您可以在触发器身份验证中配置特定的身份验证参数,如以下部分所述。根据需要,您还可以使用 secret。 - 8

- 9

- 可选:指定在 Prometheus 目标丢失时触发器应如何进行操作。

-

如果为

true,当 Prometheus 目标丢失时触发器将继续操作。这是默认的行为。 -

如果为

false,当 Prometheus 目标丢失时触发器会返回错误。

-

如果为

- 10

- 可选:指定是否应跳过证书检查。例如,如果在测试环境中运行并使用 Prometheus 端点上的自签名证书,您可以跳过检查。

-

如果为

false,则执行证书检查。这是默认的行为。 如果为

true,则不会执行证书检查。重要不建议跳过检查。

-

如果为

3.4.1.1. 配置自定义指标自动扩展以使用 Red Hat OpenShift Service on AWS 监控

您可以使用安装的 Red Hat OpenShift Service on AWS Prometheus 监控作为自定义指标自动扩展使用的指标的来源。但是,需要执行一些额外的配置。

外部 Prometheus 源不需要这些步骤。

您必须执行以下任务,如本节所述:

- 创建一个服务帐户。

- 创建为服务帐户生成令牌的 secret。

- 创建触发器身份验证。

- 创建角色。

- 将该角色添加到服务帐户。

- 在 Prometheus 使用的触发器验证对象中引用令牌。

先决条件

- 必须安装 Red Hat OpenShift Service on AWS 监控。

- 在 Red Hat OpenShift Service on AWS 监控中必须启用对 用户定义的工作负载的监控,如 创建用户定义的工作负载监控配置映射 部分所述。

- 必须安装 Custom Metrics Autoscaler Operator。

流程

使用您要缩放的对象切换到项目:

$ oc project my-project

如果集群没有服务帐户和令牌,请创建服务帐户和令牌:

使用以下命令创建

服务帐户对象:$ oc create serviceaccount thanos 1- 1

- 指定服务帐户的名称。

创建

secretYAML 来生成服务帐户令牌:apiVersion: v1 kind: Secret metadata: name: thanos-token annotations: kubernetes.io/service-account.name: thanos 1 type: kubernetes.io/service-account-token- 1

- 指定服务帐户的名称。

使用以下命令创建 secret 对象:

$ oc create -f <file_name>.yaml

使用以下命令查找分配给服务帐户的令牌:

$ oc describe serviceaccount thanos 1- 1

- 指定服务帐户的名称。

输出示例

Name: thanos Namespace: my-project Labels: <none> Annotations: <none> Image pull secrets: thanos-dockercfg-nnwgj Mountable secrets: thanos-dockercfg-nnwgj Tokens: thanos-token 1 Events: <none>- 1

- 在触发器身份验证中使用此令牌。

使用服务帐户令牌创建触发器身份验证:

创建一个类似以下示例的 YAML 文件:

apiVersion: keda.sh/v1alpha1 kind: TriggerAuthentication metadata: name: keda-trigger-auth-prometheus spec: secretTargetRef: 1 - parameter: bearerToken 2 name: thanos-token 3 key: token 4 - parameter: ca name: thanos-token key: ca.crt

创建 CR 对象:

$ oc create -f <file-name>.yaml

创建用于读取 Thanos 指标的角色:

使用以下参数创建 YAML 文件:

apiVersion: rbac.authorization.k8s.io/v1 kind: Role metadata: name: thanos-metrics-reader rules: - apiGroups: - "" resources: - pods verbs: - get - apiGroups: - metrics.k8s.io resources: - pods - nodes verbs: - get - list - watch

创建 CR 对象:

$ oc create -f <file-name>.yaml

创建用于读取 Thanos 指标的角色绑定:

创建一个类似以下示例的 YAML 文件:

apiVersion: rbac.authorization.k8s.io/v1 kind: RoleBinding metadata: name: thanos-metrics-reader 1 namespace: my-project 2 roleRef: apiGroup: rbac.authorization.k8s.io kind: Role name: thanos-metrics-reader subjects: - kind: ServiceAccount name: thanos 3 namespace: my-project 4

创建 CR 对象:

$ oc create -f <file-name>.yaml

现在,您可以部署扩展的对象或扩展作业来为应用程序启用自动扩展,如"了解如何添加自定义指标自动扩展"中所述。要将 Red Hat OpenShift Service on AWS 监控用作源,在触发器或 scaler 中,您必须包括以下参数:

-

triggers.type必须是prometheus -

triggers.metadata.serverAddress必须是https://thanos-querier.openshift-monitoring.svc.cluster.local:9092 -

triggers.metadata.authModes必须是bearer -

triggers.metadata.namespace必须设置为要缩放的对象的命名空间 -

triggers.authenticationRef必须指向上一步中指定的触发器身份验证资源

3.4.2. 了解 CPU 触发器

您可以根据 CPU 指标扩展 pod。此触发器使用集群指标作为指标的源。

自定义指标自动扩展扩展与对象关联的 pod,以维护您指定的 CPU 用量。自动缩放器增加或减少最小和最大数量之间的副本数量,以维护所有 pod 的指定 CPU 使用率。内存触发器考虑整个 pod 的内存使用率。如果 pod 有多个容器,则内存触发器会考虑 pod 中所有容器的总内存使用率。

-

此触发器不能与

ScaledJob自定义资源一起使用。 -

当使用内存触发器扩展对象时,对象不会扩展到

0,即使您使用多个触发器。

使用 CPU 目标扩展对象示例

apiVersion: keda.sh/v1alpha1 kind: ScaledObject metadata: name: cpu-scaledobject namespace: my-namespace spec: # ... triggers: - type: cpu 1 metricType: Utilization 2 metadata: value: '60' 3 minReplicaCount: 1 4

3.4.3. 了解内存触发器

您可以根据内存指标扩展 pod。此触发器使用集群指标作为指标的源。

自定义指标自动扩展扩展与对象关联的 pod,以维护您指定的平均内存用量。自动缩放器会增加和减少最小和最大数量之间的副本数量,以维护所有 pod 的指定内存使用率。内存触发器考虑整个 pod 的内存使用率。如果 pod 有多个容器,则内存使用率是所有容器的总和。

-

此触发器不能与

ScaledJob自定义资源一起使用。 -

当使用内存触发器扩展对象时,对象不会扩展到

0,即使您使用多个触发器。

使用内存目标扩展对象示例

apiVersion: keda.sh/v1alpha1 kind: ScaledObject metadata: name: memory-scaledobject namespace: my-namespace spec: # ... triggers: - type: memory 1 metricType: Utilization 2 metadata: value: '60' 3 containerName: api 4

3.4.4. 了解 Kafka 触发器

您可以根据 Apache Kafka 主题或支持 Kafka 协议的其他服务扩展 pod。自定义指标自动扩展不会缩放 Kafka 分区数量,除非在扩展的对象或扩展任务中将 allowIdleConsumers 参数设置为 true。

如果消费者组数量超过主题中的分区数量,则额外的消费者组处于闲置状态。要避免这种情况,默认情况下副本数不会超过:

- 如果指定了主题,则主题上的分区数量

- 如果没有指定主题,则消费者组中的所有主题的分区数量

-

在扩展对象或扩展作业 CR 中指定的

maxReplicaCount

您可以使用 allowIdleConsumers 参数禁用这些默认行为。

使用 Kafka 目标扩展对象示例

apiVersion: keda.sh/v1alpha1 kind: ScaledObject metadata: name: kafka-scaledobject namespace: my-namespace spec: # ... triggers: - type: kafka 1 metadata: topic: my-topic 2 bootstrapServers: my-cluster-kafka-bootstrap.openshift-operators.svc:9092 3 consumerGroup: my-group 4 lagThreshold: '10' 5 activationLagThreshold: '5' 6 offsetResetPolicy: latest 7 allowIdleConsumers: true 8 scaleToZeroOnInvalidOffset: false 9 excludePersistentLag: false 10 version: '1.0.0' 11 partitionLimitation: '1,2,10-20,31' 12 tls: enable 13

- 1

- 指定 Kafka 作为触发器类型。

- 2

- 指定 Kafka 在处理偏移滞后的 Kafka 主题的名称。

- 3

- 指定要连接的 Kafka 代理的逗号分隔列表。

- 4

- 指定用于检查主题上的偏移以及处理相关滞后的 Kafka 消费者组的名称。

- 5

- 可选:指定触发扩展的平均目标值。必须指定为带引号的字符串值。默认值为

5。 - 6

- 可选:指定激活阶段的目标值。必须指定为带引号的字符串值。

- 7

- 可选:为 Kafka 使用者指定 Kafka 偏移重置策略。可用值包括:

latest和earliest。默认为latest。 - 8

- 可选:指定 Kafka 副本数是否可以超过主题中的分区数量。

-

如果为

true,则 Kafka 副本数可能会超过主题上的分区数量。这允许闲置 Kafka 用户。 -

如果为

false,则 Kafka 副本数不能超过主题上的分区数量。这是默认值。

-

如果为

- 9

- 指定当 Kafka 分区没有有效偏移时触发器的行为方式。

-

如果为

true,则该分区的用户将缩减为零。 -

如果为

false,则 scaler 为该分区保留单个消费者。这是默认值。

-

如果为

- 10

- 可选:指定触发器是否为当前偏移与之前轮询周期的当前偏移量相同或排除分区滞后。

-

如果为

true,则扩展程序会排除这些分区中的分区滞后。 -

如果为

false,则触发器在所有分区中包含所有消费者滞后。这是默认值。

-

如果为

- 11

- 可选:指定 Kafka 代理的版本。必须指定为带引号的字符串值。默认值为

1.0.0。 - 12

- 可选:指定一个以逗号分隔的分区 ID 列表来限制缩放。如果设置,则仅考虑计算滞后列出的 ID。必须指定为带引号的字符串值。默认为考虑所有分区。

- 13

- 可选:指定是否对 Kafka 使用 TSL 客户端身份验证。默认为

禁用。有关配置 TLS 的详情,请参考 "Understanding custom metrics autoscaler trigger authentications"。

3.4.5. 了解 Cron 触发器

您可以根据时间范围扩展 pod。

当时间范围启动时,自定义指标自动扩展会将与对象关联的 pod 从配置的最少 pod 数量扩展到所需的 pod 数量。在时间范围结束时,容器集将重新扩展到配置的最小值。时间段必须以 cron 格式进行配置。

在以下示例中,从印度标准时间 6:00 AM 到 6:30 PM 时将与此扩展对象关联的 pod 从 0 扩展到 100。

使用 Cron trigger 扩展对象示例

apiVersion: keda.sh/v1alpha1

kind: ScaledObject

metadata:

name: cron-scaledobject

namespace: default

spec:

scaleTargetRef:

name: my-deployment

minReplicaCount: 0 1

maxReplicaCount: 100 2

cooldownPeriod: 300

triggers:

- type: cron 3

metadata:

timezone: Asia/Kolkata 4

start: "0 6 * * *" 5

end: "30 18 * * *" 6

desiredReplicas: "100" 7

3.5. 了解自定义指标自动扩展触发器身份验证

触发器身份验证允许您在扩展对象或可供关联容器使用的扩展作业中包含身份验证信息。您可以使用触发器身份验证来传递 Red Hat OpenShift Service on AWS secret、平台原生 pod 身份验证机制、环境变量等。

您可以在与您要缩放的对象相同的命名空间中定义一个 TriggerAuthentication 对象。该触发器身份验证只能由该命名空间中的对象使用。

另外,要在多个命名空间中对象间共享凭证,您可以创建一个可在所有命名空间中使用的 ClusterTriggerAuthentication 对象。

触发验证和集群触发器身份验证使用相同的配置。但是,集群触发器身份验证需要在扩展对象的验证引用中有一个额外的 kind 参数。

用于基本身份验证的 secret 示例

apiVersion: v1

kind: Secret

metadata:

name: my-basic-secret

namespace: default

data:

username: "dXNlcm5hbWU=" 1

password: "cGFzc3dvcmQ="

- 1

- 提供给触发器身份验证的用户名和密码。

data小节中的值必须采用 base-64 编码。

使用 secret 进行基本身份验证的触发器身份验证示例

kind: TriggerAuthentication apiVersion: keda.sh/v1alpha1 metadata: name: secret-triggerauthentication namespace: my-namespace 1 spec: secretTargetRef: 2 - parameter: username 3 name: my-basic-secret 4 key: username 5 - parameter: password name: my-basic-secret key: password

使用用于基本身份验证的 secret 的集群触发器身份验证示例

kind: ClusterTriggerAuthentication apiVersion: keda.sh/v1alpha1 metadata: 1 name: secret-cluster-triggerauthentication spec: secretTargetRef: 2 - parameter: username 3 name: my-basic-secret 4 key: username 5 - parameter: password name: my-basic-secret key: password

带有证书颁发机构 (CA) 详细信息的 secret 示例

apiVersion: v1 kind: Secret metadata: name: my-secret namespace: my-namespace data: ca-cert.pem: LS0tLS1CRUdJTiBDRVJUSUZJQ0FURS0tLS0... 1 client-cert.pem: LS0tLS1CRUdJTiBDRVJUSUZJQ0FURS0... 2 client-key.pem: LS0tLS1CRUdJTiBQUklWQVRFIEtFWS0t...

使用 secret 进行 CA 详情的触发器身份验证示例

kind: TriggerAuthentication apiVersion: keda.sh/v1alpha1 metadata: name: secret-triggerauthentication namespace: my-namespace 1 spec: secretTargetRef: 2 - parameter: key 3 name: my-secret 4 key: client-key.pem 5 - parameter: ca 6 name: my-secret 7 key: ca-cert.pem 8

带有 bearer 令牌的 secret 示例

apiVersion: v1

kind: Secret

metadata:

name: my-secret

namespace: my-namespace

data:

bearerToken: "eyJhbGciOiJIUzI1NiIsInR5cCI6IkpXV" 1

- 1

- 指定与 bearer 身份验证一起使用的 bearer 令牌。

data小节中的值必须采用 base-64 编码。

使用 bearer 令牌进行触发器身份验证示例

kind: TriggerAuthentication apiVersion: keda.sh/v1alpha1 metadata: name: token-triggerauthentication namespace: my-namespace 1 spec: secretTargetRef: 2 - parameter: bearerToken 3 name: my-secret 4 key: bearerToken 5

使用环境变量的触发器身份验证示例

kind: TriggerAuthentication apiVersion: keda.sh/v1alpha1 metadata: name: env-var-triggerauthentication namespace: my-namespace 1 spec: env: 2 - parameter: access_key 3 name: ACCESS_KEY 4 containerName: my-container 5

使用 pod 验证供应商的触发器身份验证示例

kind: TriggerAuthentication apiVersion: keda.sh/v1alpha1 metadata: name: pod-id-triggerauthentication namespace: my-namespace 1 spec: podIdentity: 2 provider: aws-eks 3

其他资源

- 有关 Red Hat OpenShift Service on AWS secret 的详情,请参考 向 pod 提供敏感数据。

3.5.1. 使用触发器身份验证

您可以使用触发器验证和集群触发器身份验证,方法是使用自定义资源来创建身份验证,然后添加对扩展对象或扩展任务的引用。

先决条件

- 必须安装 Custom Metrics Autoscaler Operator。

如果使用 secret,

Secret对象必须存在,例如:secret 示例

apiVersion: v1 kind: Secret metadata: name: my-secret data: user-name: <base64_USER_NAME> password: <base64_USER_PASSWORD>

流程

创建

TriggerAuthentication或ClusterTriggerAuthentication对象。创建定义对象的 YAML 文件:

使用 secret 的触发器验证示例

kind: TriggerAuthentication apiVersion: keda.sh/v1alpha1 metadata: name: prom-triggerauthentication namespace: my-namespace spec: secretTargetRef: - parameter: user-name name: my-secret key: USER_NAME - parameter: password name: my-secret key: USER_PASSWORD创建

TriggerAuthentication对象:$ oc create -f <filename>.yaml

创建或编辑使用触发器身份验证的

ScaledObjectYAML 文件:运行以下命令,创建定义对象的 YAML 文件:

使用触发器身份验证的扩展对象示例

apiVersion: keda.sh/v1alpha1 kind: ScaledObject metadata: name: scaledobject namespace: my-namespace spec: scaleTargetRef: name: example-deployment maxReplicaCount: 100 minReplicaCount: 0 pollingInterval: 30 triggers: - type: prometheus metadata: serverAddress: https://thanos-querier.openshift-monitoring.svc.cluster.local:9092 namespace: kedatest # replace <NAMESPACE> metricName: http_requests_total threshold: '5' query: sum(rate(http_requests_total{job="test-app"}[1m])) authModes: "basic" authenticationRef: name: prom-triggerauthentication 1 kind: TriggerAuthentication 2使用集群触发器身份验证的扩展对象示例

apiVersion: keda.sh/v1alpha1 kind: ScaledObject metadata: name: scaledobject namespace: my-namespace spec: scaleTargetRef: name: example-deployment maxReplicaCount: 100 minReplicaCount: 0 pollingInterval: 30 triggers: - type: prometheus metadata: serverAddress: https://thanos-querier.openshift-monitoring.svc.cluster.local:9092 namespace: kedatest # replace <NAMESPACE> metricName: http_requests_total threshold: '5' query: sum(rate(http_requests_total{job="test-app"}[1m])) authModes: "basic" authenticationRef: name: prom-cluster-triggerauthentication 1 kind: ClusterTriggerAuthentication 2运行以下命令来创建扩展的对象:

$ oc apply -f <filename>

3.6. 暂停扩展对象的自定义指标自动扩展

您可以根据需要暂停并重启工作负载的自动扩展。

例如,您可能想要在执行集群维护前暂停自动扩展,或通过删除非传输工作负载来避免资源不足。

3.6.1. 暂停自定义指标自动扩展

您可以通过将 autoscaling.keda.sh/paused-replicas 注解添加到扩展对象的自定义指标自动扩展中来暂停扩展对象的自动扩展。自定义指标自动扩展将该工作负载的副本扩展到指定的值,并暂停自动扩展,直到注解被删除为止。

apiVersion: keda.sh/v1alpha1

kind: ScaledObject

metadata:

annotations:

autoscaling.keda.sh/paused-replicas: "4"

# ...流程

使用以下命令编辑工作负载的

ScaledObjectCR:$ oc edit ScaledObject scaledobject

使用任何值添加

autoscaling.keda.sh/paused-replicas注解:apiVersion: keda.sh/v1alpha1 kind: ScaledObject metadata: annotations: autoscaling.keda.sh/paused-replicas: "4" 1 creationTimestamp: "2023-02-08T14:41:01Z" generation: 1 name: scaledobject namespace: my-project resourceVersion: '65729' uid: f5aec682-acdf-4232-a783-58b5b82f5dd0- 1

- 指定自定义 Metrics Autoscaler Operator 将副本扩展到指定的值,并停止自动扩展。

3.6.2. 为扩展的对象重启自定义指标自动扩展

您可以通过删除该 ScaledObject 的 autoscaling.keda.sh/paused-replicas 注解来重启暂停的自定义指标自动扩展。

apiVersion: keda.sh/v1alpha1

kind: ScaledObject

metadata:

annotations:

autoscaling.keda.sh/paused-replicas: "4"

# ...流程

使用以下命令编辑工作负载的

ScaledObjectCR:$ oc edit ScaledObject scaledobject

删除

autoscaling.keda.sh/paused-replicas注解。apiVersion: keda.sh/v1alpha1 kind: ScaledObject metadata: annotations: autoscaling.keda.sh/paused-replicas: "4" 1 creationTimestamp: "2023-02-08T14:41:01Z" generation: 1 name: scaledobject namespace: my-project resourceVersion: '65729' uid: f5aec682-acdf-4232-a783-58b5b82f5dd0- 1

- 删除此注解以重启暂停的自定义指标自动扩展。

3.7. 收集审计日志

您可以收集审计日志,它们是与安全相关的按时间排序的记录,记录各个用户、管理员或其他系统组件影响系统的一系列活动。

例如,审计日志可帮助您了解自动扩展请求来自哪里。当后端因为用户应用程序发出的请求造成过载时,这个信息非常重要,您需要确定哪个是有问题的应用程序。

3.7.1. 配置审计日志记录

您可以通过编辑 KedaController 自定义资源来为自定义 Metrics Autoscaler Operator 配置审计。日志通过 KedaController CR 中的持久性卷声明发送到卷的审计日志文件。

先决条件

- 必须安装 Custom Metrics Autoscaler Operator。

流程

编辑

KedaController自定义资源以添加auditConfig小节:kind: KedaController apiVersion: keda.sh/v1alpha1 metadata: name: keda namespace: keda spec: # ... metricsServer: # ... auditConfig: logFormat: "json" 1 logOutputVolumeClaim: "pvc-audit-log" 2 policy: rules: 3 - level: Metadata omitStages: "RequestReceived" 4 omitManagedFields: false 5 lifetime: 6 maxAge: "2" maxBackup: "1" maxSize: "50"- 1

- 指定审计日志的输出格式,可以是

legacy或json。 - 2

- 指定用于存储日志数据的现有持久性卷声明。所有来自 API 服务器的请求都会记录到此持久性卷声明。如果将此字段留空,日志数据将发送到 stdout。

- 3

- 指定应记录哪些事件及其应包含哪些数据:

-

None:不记录事件。 -

Metadata:仅记录请求的元数据,如用户、时间戳等。不要记录请求文本和响应文本。这是默认值。 -

Request:仅记录元数据和请求文本,而不记录响应文本。这个选项不适用于非资源请求。 -

RequestResponse:日志事件元数据、请求文本和响应文本。这个选项不适用于非资源请求。

-

- 4

- 指定没有创建事件的阶段。

- 5

- 指定是否省略请求的 managed 字段,并从写入 API 审计日志的响应正文,可以是

true来省略字段,或false包含字段。 - 6

- 指定审计日志的大小和生命周期。

-

MaxAge:根据文件名中编码的时间戳,保留审计日志文件的最大天数。 -

maxBackup:要保留的审计日志文件的最大数量。设置为0以保留所有审计日志文件。 -

maxsize:在轮转审计日志文件前以 MB 为单位的最大大小。

-

验证

直接查看审计日志文件:

获取

keda-metrics-apiserver the pod的名称:oc get pod -n keda

输出示例

NAME READY STATUS RESTARTS AGE custom-metrics-autoscaler-operator-5cb44cd75d-9v4lv 1/1 Running 0 8m20s keda-metrics-apiserver-65c7cc44fd-rrl4r 1/1 Running 0 2m55s keda-operator-776cbb6768-zpj5b 1/1 Running 0 2m55s

使用类似如下的命令查看日志数据:

$ oc logs keda-metrics-apiserver-<hash>|grep -i metadata 1- 1