installer-provisioned クラスターのベアメタルへのデプロイ

installer-provisioned OpenShift Container Platform クラスターをベアメタルにデプロイする

概要

第1章 概要

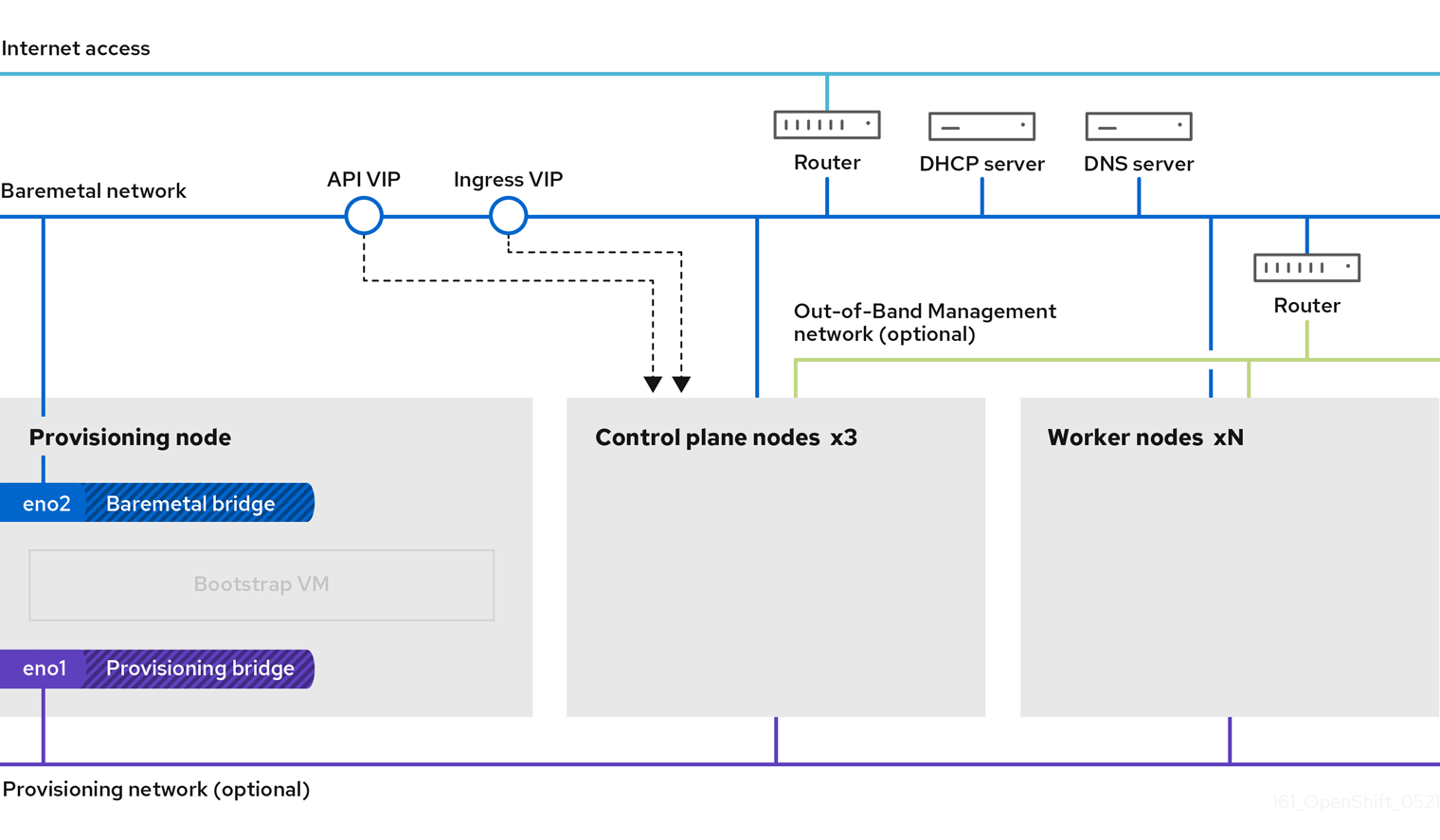

ベアメタルノードへの installer-provisioned installation は、OpenShift Container Platform クラスターが実行されるインフラストラクチャーをデプロイおよび設定します。このガイドでは、installer-provisioned ベアメタルのインストールを正常に行うための方法論を提供します。次の図は、デプロイメントのフェーズ 1 におけるインストール環境を示しています。

インストールの場合、前の図の主要な要素は次のとおりです。

- プロビジョナー: インストールプログラムを実行し、新しい OpenShift Container Platform クラスターのコントロールプレーンをデプロイするブートストラップ VM をホストする物理マシン。

- Bootstrap VM: OpenShift Container Platform クラスターのデプロイプロセスで使用される仮想マシン。

-

ネットワークブリッジ: ブートストラップ VM は、ネットワークブリッジ

eno1およびeno2を介して、ベアメタルネットワークとプロビジョニングネットワーク (存在する場合) に接続します。 -

API VIP: API 仮想 IP アドレス (VIP) は、コントロールプレーンノード全体で API サーバーのフェイルオーバーを提供するために使用されます。API VIP はまずブートストラップ仮想マシンにあります。スクリプトは、サービスを起動する前に

keepalived.conf設定ファイルを生成します。VIP は、ブートストラッププロセスが完了し、ブートストラップ仮想マシンが停止すると、コントロールプレーンノードの 1 つに移動します。

デプロイメントのフェーズ 2 では、プロビジョナーがブートストラップ VM を自動的に破棄し、仮想 IP アドレス (VIP) を適切なノードに移動します。

keepalived.conf ファイルは、コントロールプレーンマシンにブートストラップ VM よりも低い仮想ルーター冗長プロトコル (VRRP) の優先順位を設定します。これにより、API VIP がブートストラップ VM からコントロールプレーンに移動する前に、コントロールプレーンマシン上の API が完全に機能することが保証されます。API VIP がコントロールプレーンノードの 1 つに移動すると、外部クライアントから API VIP ルートに送信されたトラフィックが、そのコントロールプレーンノードで実行している haproxy ロードバランサーに移動します。haproxy のこのインスタンスは、コントロールプレーンノード全体で API VIP トラフィックを分散します。

Ingress 仮想 IP はコンピュートノードに移動します。keepalived インスタンスは Ingress VIP も管理します。

次の図は、デプロイメントのフェーズ 2 を示しています:

これ以降、プロビジョナーが使用するノードを削除または再利用できます。ここから、追加のプロビジョニングタスクはすべてコントロールプレーンによって実行されます。

installer-provisioned infrastructure によるインストールの場合、ポート 53 が CoreDNS によってノードレベルで公開され、他のルーティング可能なネットワークからアクセスできるようになります。

プロビジョニングネットワークは任意ですが、PXE ブートには必要です。プロビジョニングネットワークなしでデプロイする場合は、redfish-virtualmedia または idrac-virtualmedia などの仮想メディアベースボード管理コントローラー (BMC) アドレス指定オプションを使用する必要があります。

第2章 前提条件

OpenShift Container Platform の installer-provisioned installation には、以下が必要です。

- 1 つの Red Hat Enterprise Linux (RHEL) 9.x がインストールされているプロビジョナーノード。プロビジョナーは、インストール後に削除できます。

- 3 つのコントロールプレーンノード

- ベースボード管理コントローラー (BMC) の各ノードへのアクセス。

1 つ以上のネットワーク:

- 1 つの必須のルーティング可能なネットワーク

- 1 つのオプションのプロビジョニングネットワーク

- 1 つのオプションの管理ネットワーク

OpenShift Container Platform の installer-provisioned installation を開始する前に、ハードウェア環境が以下の要件を満たしていることを確認してください。

2.1. ノードの要件

installer-provisioned installation には、ハードウェアノードの各種の要件があります。

-

CPU architecture: すべてのノードは

x86_64またはaarch64CPU アーキテクチャーを使用する必要があります。 - 同様のノード: Red Hat では、ノードにロールごとに同じ設定を指定することを推奨しています。つまり Red Hat では、同じ CPU、メモリー、ストレージ設定の同じブランドおよびモデルのノードを使用することを推奨しています。

-

ベースボード管理コントローラー:

provisionerノードは、各 OpenShift Container Platform クラスターノードのベースボード管理コントローラー (BMC) にアクセスできる必要があります。IPMI、Redfish、またはプロプライエタリープロトコルを使用できます。 -

最新の生成: ノードは最新の生成されたノードである必要があります。installer-provisioned installation は、ノード間で互換性を確保する必要のある BMC プロトコルに依存します。また、RHEL 9 には RAID コントローラーの最新のドライバーが同梱されています。ノードが、

provisionerノードの RHEL 9.x と、コントロールプレーンおよびワーカーノードの RHCOS 9.x をサポートするために必要な新しいバージョンのノードでであることを確認します。 - レジストリーノード: (オプション) 非接続のミラーリングされていないレジストリーを設定する場合、レジストリーは独自のノードに置くことが推奨されます。

-

プロビジョナーノード: installer-provisioned installation には 1 つの

provisionerノードが必要です。 - コントロールプレーン: installer-provisioned installation には、高可用性を実現するために 3 つのコントロールプレーンノードが必要です。3 つのコントロールプレーンノードのみで OpenShift Container Platform クラスターをデプロイして、コントロールプレーンノードをワーカーノードとしてスケジュール可能にすることができます。小規模なクラスターでは、開発、実稼働およびテスト時の管理者および開発者に対するリソース効率が高くなります。

ワーカーノード: 必須ではありませんが、一般的な実稼働クラスターには複数のワーカーノードがあります。

重要ワーカーノードが 1 つしかないクラスターは、パフォーマンスが低下した状態のルーターおよび Ingress トラフィックでデプロイされるので、デプロイしないでください。

ネットワークインターフェイス: 各ノードでは、ルーティング可能な

baremetalネットワークに 1 つ以上のネットワークインターフェイスが必要です。デプロイメントにprovisioningネットワークを使用する場合、各ノードにprovisioningネットワーク用に 1 つのネットワークインターフェイスが必要になります。provisioningネットワークの使用はデフォルト設定です。注記同じサブネット上の 1 つのネットワークカード (NIC) のみが、ゲートウェイ経由でトラフィックをルーティングできます。デフォルトでは、アドレス解決プロトコル (ARP) は番号が最も小さい NIC を使用します。ネットワーク負荷分散が期待どおりに機能するようにするには、同じサブネット内の各ノードに 1 つの NIC を使用します。同じサブネット内のノードに複数の NIC を使用する場合は、単一のボンディングまたはチームインターフェイスを使用します。次に、エイリアス IP アドレスの形式で他の IP アドレスをそのインターフェイスに追加します。ネットワークインターフェイスレベルでフォールトトレランスまたは負荷分散が必要な場合は、ボンディングまたはチームインターフェイスでエイリアス IP アドレスを使用します。または、同じサブネットでセカンダリー NIC を無効にするか、IP アドレスがないことを確認できます。

Unified Extensible Firmware Interface (UEFI): installer-provisioned installation では、

provisioningネットワークで IPv6 アドレスを使用する場合に、すべての OpenShift Container Platform ノードで UEFI ブートが必要になります。さらに、UEFI Device PXE Settings (UEFI デバイス PXE 設定) はprovisioningネットワーク NIC で IPv6 プロトコルを使用するように設定する必要がありますが、provisioningネットワークを省略すると、この要件はなくなります。重要ISO イメージなどの仮想メディアからインストールを開始する場合は、古い UEFI ブートテーブルエントリーをすべて削除します。ブートテーブルに、ファームウェアによって提供される一般的なエントリーではないエントリーが含まれている場合、インストールは失敗する可能性があります。

Secure Boot: 多くの実稼働シナリオでは、UEFI ファームウェアドライバー、EFI アプリケーション、オペレーティングシステムなど、信頼できるソフトウェアのみを使用してノードが起動することを確認するために、Secure Boot が有効にされているノードが必要です。手動またはマネージドの Secure Boot を使用してデプロイすることができます。

- 手動: 手動で Secure Boot を使用して OpenShift Container Platform クラスターをデプロイするには、UEFI ブートモードおよび Secure Boot を各コントロールプレーンノードおよび各ワーカーノードで有効にする必要があります。Red Hat は、installer-provisioned installation で Redfish 仮想メディアを使用している場合にのみ、手動で有効にした UEFI および Secure Boot で、Secure Boot をサポートします。詳細は、「ノードの設定」セクションの「手動での Secure Boot のノードの設定」を参照してください。

マネージド: マネージド Secure Boot で OpenShift Container Platform クラスターをデプロイするには、

install-config.yamlファイルでbootModeの値をUEFISecureBootに設定する必要があります。Red Hat は、第 10 世代 HPE ハードウェアおよび 13 世代 Dell ハードウェア (ファームウェアバージョン2.75.75.75以上を実行) でマネージド Secure Boot を使用した installer-provisioned installation のみをサポートします。マネージド Secure Boot を使用したデプロイには、Redfish 仮想メディアは必要ありません。詳細は、「OpenShift インストールの環境のセットアップ」セクションの「マネージド Secure Boot の設定」を参照してください。注記Red Hat は、セキュアブートの自己生成キーまたは他のキーの管理をサポートしていません。

2.2. クラスターインストールの最小リソース要件

それぞれのクラスターマシンは、以下の最小要件を満たしている必要があります。

| マシン | オペレーティングシステム | CPU [1] | RAM | ストレージ | 1 秒あたりの入出力 (IOPS) [2] |

|---|---|---|---|---|---|

| ブートストラップ | RHEL | 4 | 16 GB | 100 GB | 300 |

| コントロールプレーン | RHCOS | 4 | 16 GB | 100 GB | 300 |

| Compute | RHCOS | 2 | 8 GB | 100 GB | 300 |

- 1 つの CPU は、同時マルチスレッド (SMT) またはハイパースレッディングが有効にされていない場合に 1 つの物理コアと同等です。これが有効にされている場合、(コアごとのスレッド x コア数) x ソケット数 = CPU という数式を使用して対応する比率を計算します。

- OpenShift Container Platform と Kubernetes は、ディスクのパフォーマンスの影響を受けるため、特にコントロールプレーンノードの etcd には、より高速なストレージが推奨されます。多くのクラウドプラットフォームでは、ストレージサイズと IOPS スケールが一緒にあるため、十分なパフォーマンスを得るためにストレージボリュームの割り当てが必要になる場合があります。

OpenShift Container Platform バージョン 4.13 の時点で、RHCOS は RHEL バージョン 9.2 に基づいており、マイクロアーキテクチャーの要件を更新します。次のリストには、各アーキテクチャーに必要な最小限の命令セットアーキテクチャー (ISA) が含まれています。

- x86-64 アーキテクチャーには x86-64-v2 ISA が必要

- ARM64 アーキテクチャーには ARMv8.0-A ISA が必要

- IBM Power アーキテクチャーには Power 9 ISA が必要

- s390x アーキテクチャーには z14 ISA が必要

詳細は、アーキテクチャー (RHEL ドキュメント) を参照してください。

プラットフォームのインスタンスタイプがクラスターマシンの最小要件を満たす場合、これは OpenShift Container Platform で使用することがサポートされます。

2.3. OpenShift Virtualization のベアメタルクラスターのインストール要件

ベアメタルクラスターで OpenShift Virtualization を使用する予定がある場合は、インストール時にクラスターが正しく設定されていることを確認する必要があります。これは、OpenShift Virtualization ではクラスターのインストール後に変更できない特定の設定が必要なためです。

2.3.1. OpenShift Virtualization の高可用性要件

OpenShift Virtualization のコンテキストで高可用性(HA)機能について話す場合、これは、Infrastructure カスタムリソース(CR)の controlPlaneTopology フィールドと infrastructureTopology フィールドで決定されるコアクラスターコンポーネントのレプリケーションモデルのみを指します。これらのフィールドを HighlyAvailable に設定すると、一般的なアプリケーション HA とは異なるコンポーネントの冗長性が提供されます。これらのフィールドを SingleReplica に設定すると、コンポーネントの冗長性が無効になるため、OpenShift Virtualization HA 機能が無効になります。

OpenShift Virtualization HA 機能を使用する予定がある場合は、クラスターのインストール時に 3 つのコントロールプレーンノードが必要です。クラスターの インフラストラクチャー CR の controlPlaneTopology ステータスは、HighlyAvailable である必要があります。

単一ノードのクラスターに OpenShift Virtualization をインストールできますが、単一ノードの OpenShift は HA 機能をサポートしていません。

2.3.2. OpenShift Virtualization のライブマイグレーション要件

ライブマイグレーションを使用する予定の場合には、複数のワーカーノードが必要です。クラスターのインフラストラクチャー CR の

infrastructureTopologyステータスはHighlyAvailableであり、最低でも 3 つのワーカーノードが推奨されます。注記単一ノードのクラスターに OpenShift Virtualization をインストールできますが、単一ノードの OpenShift はライブマイグレーションをサポートしていません。

- ライブマイグレーションには共有ストレージが必要です。OpenShift Virtualization のストレージは、ReadWriteMany (RWX) アクセスモードをサポートし、使用する必要があります。

2.3.3. OpenShift Virtualization の SR-IOV 要件

Single Root I/O Virtualization (SR-IOV) を使用する予定の場合は、ネットワークインターフェイスコントローラー (NIC) が OpenShift Container Platform でサポートされていることを確認してください。

2.4. 仮想メディアを使用したインストールのファームウェア要件

installer-provisioned OpenShift Container Platform クラスターのインストールプログラムは、Redfish 仮想メディアとのハードウェアおよびファームウェアの互換性を検証します。ノードファームウェアに互換性がない場合、インストールプログラムはノードへのインストールを開始しません。以下の表は、Redfish 仮想メディアを使用してデプロイされる installer-provisioned OpenShift Container Platform クラスターで機能するようにテストおよび検証された最小ファームウェアバージョンの一覧です。

Red Hat は、ファームウェア、ハードウェア、またはその他のサードパーティーコンポーネントの組み合わせをすべてテストしません。サードパーティーサポートの詳細は、Red Hat サードパーティーサポートポリシー を参照してください。ファームウェアの更新は、ノードのハードウェアドキュメントを参照するか、ハードウェアベンダーにお問い合わせください。

| モデル | 管理 | ファームウェアのバージョン |

|---|---|---|

| 第 11 世代 | iLO6 | 1.57 以降 |

| 第 10 世代 | iLO5 | 2.63 以降 |

| モデル | 管理 | ファームウェアのバージョン |

|---|---|---|

| 第 16 世代 | iDRAC 9 | v7.10.70.00 |

| 第 15 世代 | iDRAC 9 | v6.10.30.00 および v7.10.70.00 |

| 第 14 世代 | iDRAC 9 | v6.10.30.00 |

| モデル | 管理 | ファームウェアのバージョン |

|---|---|---|

| UCS UCSX-210C-M6 | CIMC | 5.2(2) 以降 |

2.5. ネットワーク要件

OpenShift Container Platform の installer-provisioned installation には、複数のネットワーク要件があります。まず、installer-provisioned installation では、各ベアメタルノードにオペレーティングシステムをプロビジョニングするためのルーティング不可能な provisioning ネットワークをオプションで使用します。次に、installer-provisioned installation では、ルーティング可能な baremetal ネットワークを使用します。

2.5.1. 必須ポートが開いていることを確認する

クラスター間で特定のノードが開いてなければ、installer-provisioned によるインストールは正常に完了しません。ファーエッジワーカーノードに別のサブネットを使用する場合などの特定の状況では、これらのサブネット内のノードが、次の必須ポートで他のサブネット内のノードと通信できることを確認する必要があります。

| ポート | 説明 |

|---|---|

|

|

プロビジョニングネットワークを使用する場合、クラスターノードは、ポート |

|

|

プロビジョニングネットワークを使用する場合、クラスターノードはプロビジョニングネットワークインターフェイスを使用してポート |

|

|

イメージキャッシュオプションを使用しない場合、または仮想メディアを使用する場合、プロビジョナーノードからクラスターノードに Red Hat Enterprise Linux CoreOS (RHCOS) イメージをストリーミングするには、プロビジョナーノードのポート |

|

|

クラスターノードは、 |

|

|

Ironic Inspector API は、コントロールプレーンノード上で実行され、ポート |

|

|

ポート |

|

|

仮想メディアを使用して TLS を使用せずにデプロイする場合、ワーカーノードのベースボード管理コントローラー (BMC) が RHCOS イメージにアクセスできるように、プロビジョナーノードとコントロールプレーンノードのポート |

|

|

仮想メディアを使用して TLS でデプロイする場合、ワーカーノードの BMC が RHCOS イメージにアクセスできるように、プロビジョナーノードとコントロールプレーンノードのポート |

|

|

Ironic API サーバーは、最初はブートストラップ仮想マシン上で実行され、その後はコントロールプレーンノード上で実行され、ポート |

|

|

ポート |

|

|

TLS なしでイメージキャッシュを使用する場合、ポート |

|

|

TLS ありでイメージキャッシュオプションを使用する場合、ポート |

|

|

デフォルトでは、Ironic Python Agent (IPA) は、ポート |

2.5.2. ネットワーク MTU の増加

OpenShift Container Platform をデプロイする前に、ネットワークの最大伝送単位 (MTU) を 1500 以上に増やします。MTU が 1500 未満の場合、ノードの起動に使用される Ironic イメージが Ironic インスペクター Pod との通信に失敗し、検査が失敗する可能性があります。これが発生すると、インストールにノードを使用できないため、インストールが停止します。

2.5.3. NIC の設定

OpenShift Container Platform は、2 つのネットワークを使用してデプロイします。

provisioning:provisioningネットワークは、OpenShift Container Platform クラスターの一部である基礎となるオペレーティングシステムを各ノードにプロビジョニングするために使用されるオプションのルーティング不可能なネットワークです。各クラスターノードのprovisioningネットワークのネットワークインターフェイスには、BIOS または UEFI が PXE ブートに設定されている必要があります。provisioningNetworkInterface設定は、コントロールプレーンノード上のprovisioningネットワークの NIC 名を指定します。これは、コントロールプレーンノードと同じでなければなりません。bootMACAddress設定は、provisioningネットワーク用に各ノードで特定の NIC を指定する手段を提供します。provisioningネットワークは任意ですが、PXE ブートには必要です。provisioningネットワークなしでデプロイする場合、redfish-virtualmediaやidrac-virtualmediaなどの仮想メディア BMC アドレス指定オプションを使用する必要があります。-

baremetal:baremetalネットワークはルーティング可能なネットワークです。NIC がprovisioningネットワークを使用するように設定されていない場合には、baremetalネットワークとのインターフェイスには任意の NIC を使用することができます。

VLAN を使用する場合、それぞれの NIC は、適切なネットワークに対応する別個の VLAN 上にある必要があります。

2.5.4. DNS 要件

クライアントは、baremetal ネットワークで OpenShift Container Platform クラスターにアクセスします。ネットワーク管理者は、正規名の拡張がクラスター名であるサブドメインまたはサブゾーンを設定する必要があります。

<cluster_name>.<base_domain>以下に例を示します。

test-cluster.example.comOpenShift Container Platform には、クラスターメンバーシップ情報を使用して A/AAAA レコードを生成する機能が含まれます。これにより、ノード名が IP アドレスに解決されます。ノードが API に登録されると、クラスターは CoreDNS-mDNS を使用せずにこれらのノード情報を分散できます。これにより、マルチキャスト DNS に関連付けられたネットワークトラフィックがなくなります。

CoreDNS を正しく機能させるには、アップストリームの DNS サーバーへの TCP 接続と UDP 接続の両方が必要です。アップストリームの DNS サーバーが OpenShift Container Platform クラスターノードから TCP 接続と UDP 接続の両方を受信できることを確認します。

OpenShift Container Platform のデプロイメントでは、以下のコンポーネントに DNS 名前解決が必要です。

- The Kubernetes API

- OpenShift Container Platform のアプリケーションワイルドカード Ingress API

A/AAAA レコードは名前解決に使用され、PTR レコードは逆引き名前解決に使用されます。Red Hat Enterprise Linux CoreOS (RHCOS) は、逆引きレコードまたは DHCP を使用して、すべてのノードのホスト名を設定します。

installer-provisioned installation には、クラスターメンバーシップ情報を使用して A/AAAA レコードを生成する機能が含まれています。これにより、ノード名が IP アドレスに解決されます。各レコードで、<cluster_name> はクラスター名で、<base_domain> は、install-config.yaml ファイルに指定するベースドメインです。完全な DNS レコードは <component>.<cluster_name>.<base_domain>. の形式を取ります。

| コンポーネント | レコード | 説明 |

|---|---|---|

| Kubernetes API |

| A/AAAA レコードと PTR レコード。API ロードバランサーを識別します。これらのレコードは、クラスター外のクライアントおよびクラスター内のすべてのノードで解決できる必要があります。 |

| ルート |

| ワイルドカード A/AAAA レコードは、アプリケーションの Ingress ロードバランサーを参照します。アプリケーション Ingress ロードバランサーは、Ingress コントローラー Pod を実行するノードをターゲットにします。Ingress Controller Pod は、デフォルトでワーカーノードで実行されます。これらのレコードは、クラスター外のクライアントおよびクラスター内のすべてのノードで解決できる必要があります。

たとえば、 |

dig コマンドを使用して、DNS 解決を確認できます。

2.5.5. Dynamic Host Configuration Protocol (DHCP) の要件

デフォルトでは、installer-provisioned installation は、provisioning ネットワーク用に DHCP を有効にして ironic-dnsmasq をデプロイします。provisioningNetwork 設定が、デフォルト値の managed に設定されている場合、provisioning ネットワーク上で他の DHCP サーバーを実行することはできません。provisioning ネットワーク上で DHCP サーバーを実行している場合は、install-config.yaml ファイルで provisioningNetwork 設定を unmanaged に設定する必要があります。

ネットワーク管理者は、外部 DHCP サーバー上の baremetal ネットワーク用に、OpenShift Container Platform クラスター内の各ノードの IP アドレスを予約する必要があります。

2.5.6. DHCP サーバーを使用するノードの IP アドレスの確保

baremetal ネットワークの場合、ネットワーク管理者は、以下を含むいくつかの IP アドレスを予約する必要があります。

2 つの一意の仮想 IP アドレス。

- API エンドポイントの 1 つの仮想 IP アドレス。

- ワイルドカード Ingress エンドポイントの 1 つの仮想 IP アドレス

- プロビジョナーノードの 1 つの IP アドレス

- コントロールプレーンノードごとに 1 つの IP アドレス。

- 各ワーカーノードの 1 つの IP アドレス (適用可能な場合)

一部の管理者は、各ノードの IP アドレスが DHCP サーバーがない状態で一定になるように静的 IP アドレスの使用を選択します。NMState を使用して静的 IP アドレスを設定する場合は、「OpenShift インストールの環境のセットアップ」セクションの「ホストネットワークインターフェイスの設定 (オプション)」を参照してください。

外部の負荷分散サービスとコントロールプレーンノードは同じ L2 ネットワークで実行する必要があります。また、VLAN を使用して負荷分散サービスとコントロールプレーンノード間のトラフィックをルーティングする際に同じ VLAN で実行する必要があります。

ストレージインターフェイスには、DHCP 予約または静的 IP が必要です。

以下の表は、完全修飾ドメイン名の具体例を示しています。API およびネームサーバーのアドレスは、正規名の拡張で始まります。コントロールプレーンおよびワーカーノードのホスト名は例であるため、任意のホストの命名規則を使用することができます。

| 使用法 | ホスト名 | IP |

|---|---|---|

| API |

|

|

| Ingress LB (アプリケーション) |

|

|

| プロビジョナーノード |

|

|

| Control-plane-0 |

|

|

| Control-plane-1 |

|

|

| Control-plane-2 |

|

|

| Worker-0 |

|

|

| Worker-1 |

|

|

| Worker-n |

|

|

DHCP 予約を作成しない場合、Kubernetes API ノード、プロビジョナーノード、コントロールプレーンノード、およびワーカーノードのホスト名を設定するために、インストールプログラムで逆引き DNS 解決が必要になります。

2.5.7. プロビジョナーノードの要件

インストール設定でプロビジョナーノードの MAC アドレスを指定する必要があります。通常、bootMacAddress 仕様は PXE ネットワークブートに関連付けられています。ただし、Ironic プロビジョニングサービスでは、クラスターの検査中またはクラスター内のノードの再デプロイ中にノードを識別するために、bootMacAddress 仕様も必要です。

プロビジョナーノードには、ネットワークの起動、DHCP と DNS の解決、およびローカルネットワーク通信のためのレイヤー 2 接続が必要です。プロビジョナーノードには、仮想メディアの起動にレイヤー 3 接続が必要です。

2.5.8. ネットワークタイムプロトコル (NTP)

クラスター内の各 OpenShift Container Platform ノードは NTP サーバーにアクセスできる必要があります。OpenShift Container Platform ノードは NTP を使用してクロックを同期します。たとえば、クラスターノードは検証を必要とする SSL/TLS 証明書を使用しますが、ノード間の日付と時刻が同期していないと、検証が失敗する可能性があります。

各クラスターノードの BIOS 設定で一貫性のあるクロックの日付と時刻の形式を定義してください。そうしないと、インストールが失敗する可能性があります。

切断されたクラスター上で NTP サーバーとして機能するようにコントロールプレーンノードを再設定し、コントロールプレーンノードから時間を取得するようにワーカーノードを再設定することができます。

2.5.9. 帯域外管理 IP アドレスのポートアクセス

帯域外管理 IP アドレスは、ノードとは別のネットワーク上にあります。インストール中に帯域外管理がプロビジョナーノードと確実に通信できるようにするには、帯域外管理 IP アドレスに、プロビジョナーノードおよび OpenShift Container Platform コントロールプレーンノード上のポート 6180 へのアクセスを許可する必要があります。TLS ポート 6183 は、たとえば Redfish などを使用する仮想メディアのインストールに必要です。

2.6. ノードの設定

2.6.1. provisioning ネットワークを使用する場合のノードの設定

クラスター内の各ノードには、適切なインストールを行うために以下の設定が必要です。

ノード間で一致していないと、インストールに失敗します。

クラスターノードには 3 つ以上の NIC を追加できますが、インストールプロセスでは最初の 2 つの NIC のみに焦点が当てられます。以下の表では、NIC1 は OpenShift Container Platform クラスターのインストールにのみ使用されるルーティング不可能なネットワーク (provisioning) です。

| NIC | ネットワーク | VLAN |

|---|---|---|

| NIC1 |

|

|

| NIC2 |

|

|

プロビジョナーノードでの Red Hat Enterprise Linux (RHEL) 9.x インストールプロセスは異なる可能性があります。ローカルの Satellite サーバー、PXE サーバー、PXE 対応の NIC2 を使用して Red Hat Enterprise Linux (RHEL) 9.x をインストールする場合は、以下のようになります。

| PXE | ブート順序 |

|---|---|

|

NIC1 PXE 対応の | 1 |

|

NIC2 | 2 |

他のすべての NIC で PXE が無効になっていることを確認します。

コントロールプレーンおよびワーカーノードを以下のように設定します。

| PXE | ブート順序 |

|---|---|

| NIC1 PXE 対応 (プロビジョニングネットワーク) | 1 |

2.6.2. provisioning ネットワークを使用しないノードの設定

インストールプロセスには、1 つの NIC が必要です。

| NIC | ネットワーク | VLAN |

|---|---|---|

| NICx |

|

|

NICx は、OpenShift Container Platform クラスターのインストールに使用されるルーティング可能なネットワーク (baremetal) であり、インターネットにルーティング可能です。

provisioning ネットワークは任意ですが、PXE ブートには必要です。provisioning ネットワークなしでデプロイする場合、redfish-virtualmedia や idrac-virtualmedia などの仮想メディア BMC アドレス指定オプションを使用する必要があります。

2.6.3. 手動での Secure Boot のノードの設定

Secure Boot は、ノードが UEFI ファームウェアドライバー、EFI アプリケーション、オペレーティングシステムなどの信頼できるソフトウェアのみを使用していることを確認できない場合は、ノードの起動を阻止します。

Red Hat は、Redfish 仮想メディアを使用してデプロイする場合にのみ、手動で設定された Secure Boot をサポートします。

Secure Boot を手動で有効にするには、ノードのハードウェアガイドを参照し、以下を実行してください。

手順

- ノードを起動し、BIOS メニューを入力します。

-

ノードのブートモードを

UEFI Enabledに設定します。 - Secure Boot を有効にします。

Red Hat は、自己生成したキーを使用する Secure Boot をサポートしません。

2.7. アウトオブバンド管理

ノードには通常、ベースボード管理コントローラー (BMC) が使用する追加の NIC があります。この BMC はプロビジョナーノードからアクセスできる必要があります。

各ノードは、アウトオブバンド管理を介してアクセスできる必要があります。アウトオブバンド管理ネットワークを使用する場合、OpenShift Container Platform のインストールを正常に行うには、プロビジョナーノードがアウトオブバンド管理ネットワークにアクセスできる必要があります。

アウトオブバンド管理の設定は、このドキュメントの範囲外です。アウトオブバンド管理用に別の管理ネットワークを使用すると、パフォーマンスが向上し、セキュリティーが強化されます。ただし、provisioning ネットワークまたはベアメタルネットワークの使用は有効なオプションになります。

ブートストラップ仮想マシンには、最大 2 つのネットワークインターフェイスがあります。帯域外管理用に別の管理ネットワークを設定し、プロビジョニングネットワークを使用している場合、ブートストラップ仮想マシンでは、いずれかのネットワークインターフェイスを介して管理ネットワークへのルーティングアクセスが必要になります。このシナリオでは、ブートストラップ仮想マシンは 3 つのネットワークにアクセスできます。

- ベアメタルネットワーク

- プロビジョニングネットワーク

- 管理インターフェイスの 1 つを介してルーティングされる管理ネットワーク

2.8. インストールに必要なデータ

OpenShift Container Platform クラスターのインストール前に、すべてのクラスターノードから以下の情報を収集します。

アウトオブバンド管理 IP

例

- Dell (iDRAC) IP

- HP (iLO) IP

- Fujitsu (iRMC) IP

provisioning ネットワークを使用する場合

-

NIC (

provisioning) MAC アドレス -

NIC (

baremetal) MAC アドレス

provisioning ネットワークを省略する場合

-

NIC (

baremetal) MAC アドレス

2.9. ノードの検証チェックリスト

provisioning ネットワークを使用する場合

-

❏ NIC1 VLAN が

provisioningネットワーに設定されている。 -

❏

provisioningネットワークの NIC1 は、プロビジョナー、コントロールプレーン、およびワーカーノードで PXE 対応として使用できる。 -

❏ NIC2 VLAN が

baremetalネットワークに設定されている。 - ❏ PXE が他のすべての NIC で無効にされている。

- ❏ DNS は API および Ingress エンドポイントで設定されている。

- ❏ コントロールプレーンおよびワーカーノードが設定されている。

- ❏ すべてのノードがアウトオブバンド管理でアクセス可能である。

- ❏ (オプション) 別個の管理ネットワークが作成されている。

- ❏ インストールに必要なデータ。

provisioning ネットワークを省略する場合

-

❏ NIC1 VLAN が

baremetalネットワークに設定されている。 - ❏ DNS は API および Ingress エンドポイントで設定されている。

- ❏ コントロールプレーンおよびワーカーノードが設定されている。

- ❏ すべてのノードがアウトオブバンド管理でアクセス可能である。

- ❏ (オプション) 別個の管理ネットワークが作成されている。

- ❏ インストールに必要なデータ。

2.10. インストールの概要

インストールプログラムは対話型モードをサポートしています。ただし、すべてのベアメタルホストのプロビジョニングの詳細と関連するクラスターの詳細を含む install-config.yaml ファイルを事前に準備することができます。

インストールプログラムは install-config.yaml ファイルを読み込み、管理者はマニフェストを生成し、すべての前提条件を確認します。

インストールプログラムは次のタスクを実行します。

- クラスター内のすべてのノードを登録する

- ブートストラップ仮想マシン (VM) を起動する

次のコンテナーを持つ、metal プラットフォームコンポーネントを

systemdサービスとして起動する- Ironic-dnsmasq: プロビジョニングネットワーク上のさまざまなノードのプロビジョニングインターフェイスに IP アドレスを引き渡す役割を担う DHCP サーバー。Ironic-dnsmasq は、プロビジョニングネットワークを使用して OpenShift Container Platform クラスターをデプロイする場合にのみ有効になります。

- Ironic-httpd: イメージをノードに送信するために使用される HTTP サーバー。

- Image-customization

- Ironic

- Ironic-inspector (OpenShift Container Platform 4.16 以前で利用可能)

- Ironic-ramdisk-logs

- Extract-machine-os

- Provisioning-interface

- Metal3-baremetal-operator

ノードは検証フェーズに入り、Ironic がベースボード管理コントローラー (BMC) にアクセスするための認証情報を検証した後、各ノードは 管理可能 な状態に移行します。

ノードが管理可能な状態になると、検査 フェーズが開始されます。検査フェーズでは、ハードウェアが OpenShift Container Platform の正常なデプロイメントに必要な最小要件を満たしていることを確認します。

install-config.yaml ファイルには、プロビジョニングネットワークの詳細が記述されています。ブートストラップ仮想マシンでは、インストールプログラムは Pre-Boot Execution Environment (PXE) を使用して、Ironic Python Agent (IPA) がロードされているすべてのノードにライブイメージをプッシュします。仮想メディアを使用する場合、各ノードの BMC に直接接続してイメージを仮想的にアタッチします。

PXE ブートを使用する場合、プロセスを開始するためにすべてのノードが再起動します。

-

ブートストラップ仮想マシン上で実行されている

ironic-dnsmasqサービスは、ノードと TFTP ブートサーバーの IP アドレスを提供します。 - 最初のブートソフトウェアは、HTTP 経由でルートファイルシステムをロードします。

-

ブートストラップ仮想マシン上の

ironicサービスは、各ノードからハードウェア情報を受信します。

ノードはクリーニング状態になり、各ノードは設定を続行する前にすべてのディスクをクリーニングする必要があります。

クリーニング状態が終了すると、ノードは使用可能な状態になり、インストールプログラムはノードをデプロイ状態に移動します。

IPA は coreos-installer コマンドを実行して、install-config.yaml ファイルの rootDeviceHints パラメーターで定義されたディスクに Red Hat Enterprise Linux CoreOS (RHCOS)イメージをインストールします。ノードは RHCOS を使用して起動します。

インストールプログラムは、コントロールプレーンノードを設定した後、ブートストラップ仮想マシンからコントロールプレーンノードに制御を移動し、ブートストラップ仮想マシンを削除します。

ベアメタル Operator は、ワーカー、ストレージ、およびインフラノードのデプロイメントを継続します。

インストールが完了すると、ノードはアクティブ状態に移行します。その後、インストール後の設定やその他の Day 2 タスクに進むことができます。

第3章 OpenShift インストールの環境のセットアップ

3.1. RHEL のプロビジョナーノードへのインストール

前提条件の設定が完了したら、次のステップとして RHEL 9.x をプロビジョナーノードにインストールします。インストーラーは、OpenShift Container Platform クラスターをインストールする間にプロビジョナーノードをオーケレーターとして使用します。このドキュメントの目的上、RHEL のプロビジョナーノードへのインストールは対象外です。ただし、オプションには、RHEL Satellite サーバー、PXE、またはインストールメディアの使用も含まれますが、これらに限定されません。

3.2. OpenShift Container Platform インストールのプロビジョナーノードの準備

環境を準備するには、以下の手順を実行します。

手順

-

sshでプロビジョナーノードにログインします。 root 以外のユーザー (

kni) を作成し、そのユーザーにsudo権限を付与します。# useradd kni# passwd kni# echo "kni ALL=(root) NOPASSWD:ALL" | tee -a /etc/sudoers.d/kni# chmod 0440 /etc/sudoers.d/kni新規ユーザーの

sshキーを作成します。# su - kni -c "ssh-keygen -t ed25519 -f /home/kni/.ssh/id_rsa -N ''"プロビジョナーノードで新規ユーザーとしてログインします。

# su - kniRed Hat Subscription Manager を使用してプロビジョナーノードを登録します。

$ sudo subscription-manager register --username=<user> --password=<pass> --auto-attach$ sudo subscription-manager repos --enable=rhel-9-for-<architecture>-appstream-rpms --enable=rhel-9-for-<architecture>-baseos-rpms注記Red Hat Subscription Manager の詳細は、Using and Configuring Red Hat Subscription Manager を参照してください。

以下のパッケージをインストールします。

$ sudo dnf install -y libvirt qemu-kvm mkisofs python3-devel jq ipmitoolユーザーを変更して、新たに作成したユーザーに

libvirtグループを追加します。$ sudo usermod --append --groups libvirt <user>firewalldを再起動して、httpサービスを有効にします。$ sudo systemctl start firewalld$ sudo firewall-cmd --zone=public --add-service=http --permanent$ sudo firewall-cmd --reloadモジュラー

libvirtデーモンのソケットを起動します。$ for drv in qemu interface network nodedev nwfilter secret storage; do sudo systemctl start virt${drv}d{,-ro,-admin}.socket; donedefaultストレージプールを作成して、これを起動します。$ sudo virsh pool-define-as --name default --type dir --target /var/lib/libvirt/images$ sudo virsh pool-start default$ sudo virsh pool-autostart defaultpull-secret.txtファイルを作成します。$ vim pull-secret.txtWeb ブラウザーで、Install OpenShift on Bare Metal with installer-provisioned infrastructure に移動します。Copy pull secret をクリックします。

pull-secret.txtファイルにコンテンツを貼り付け、そのコンテンツをkniユーザーのホームディレクトリーに保存します。

3.3. NTP サーバーの同期を確認する

OpenShift Container Platform インストールプログラムは、chrony Network Time Protocol (NTP) サービスをクラスターノードにインストールします。インストールを完了するには、各ノードが NTP タイムサーバーにアクセスできる必要があります。chrony サービスを使用して、NTP サーバーの同期を確認できます。

切断されたクラスターの場合は、コントロールプレーンノード上で NTP サーバーを設定する必要があります。詳細は、関連情報 セクションを参照してください。

前提条件

-

ターゲットノードに

chronyパッケージがインストールされました。

手順

-

sshコマンドを使用してノードにログインします。 次のコマンドを実行して、ノードで利用可能な NTP サーバーを表示します。

$ chronyc sources出力例

MS Name/IP address Stratum Poll Reach LastRx Last sample =============================================================================== ^+ time.cloudflare.com 3 10 377 187 -209us[ -209us] +/- 32ms ^+ t1.time.ir2.yahoo.com 2 10 377 185 -4382us[-4382us] +/- 23ms ^+ time.cloudflare.com 3 10 377 198 -996us[-1220us] +/- 33ms ^* brenbox.westnet.ie 1 10 377 193 -9538us[-9761us] +/- 24mspingコマンドを使用して、ノードが NTP サーバーにアクセスできることを確認します。次に例を示します。$ ping time.cloudflare.com出力例

PING time.cloudflare.com (162.159.200.123) 56(84) bytes of data. 64 bytes from time.cloudflare.com (162.159.200.123): icmp_seq=1 ttl=54 time=32.3 ms 64 bytes from time.cloudflare.com (162.159.200.123): icmp_seq=2 ttl=54 time=30.9 ms 64 bytes from time.cloudflare.com (162.159.200.123): icmp_seq=3 ttl=54 time=36.7 ms ...

3.4. ネットワークの設定

インストールの前に、プロビジョナーノードのネットワーク設定を設定する必要があります。インストーラーによってプロビジョニングされたクラスターは、ベアメタルブリッジとネットワークリソース、およびオプションの provisioning ブリッジとネットワークリソースを使用してデプロイされます。

OpenShift Container Platform Web コンソールからネットワーク設定を設定することもできます。

前提条件

-

sudo dnf install -y <package_name> コマンドでいる。パッケージにはnmstateパッケージをインストールしてnmstatectlCLI が含まれます。

手順

ベアメタルネットワークを設定します。

注記ベアメタルネットワークとセキュアシェル(SSH)接続の切断を設定する場合、NMState には、設定を自動的に元に戻すロールバックメカニズムがあります。

nmstatectl gcツールを使用して、指定されたネットワーク状態ファイルの設定ファイルを生成することもできます。DHCP を使用するネットワークの場合は、以下のコマンドを実行して、

/etc/sysconfig/network-scripts/ifcfg-eth0レガシースタイルを削除します。$ nmcli con delete "System <baremetal_nic_name>"ここでは、以下のようになります。

<baremetal_nic_name>-

<

;baremetal_nic_name> をネットワークインターフェイスコントローラー(NIC)の名前に置き換えます。

DHCP (Dynamic Host Configuration Protocol)を使用するネットワークの場合、NMState YAML ファイルを作成し、ファイル内のベアメタルブリッジインターフェイスと物理インターフェイスを指定します。

DHCP を使用するベアメタルブリッジインターフェイスの設定例

# ... interfaces: - name: <physical_interface_name> type: ethernet state: up ipv4: enabled: false ipv6: enabled: false - name: baremetal type: linux-bridge state: up ipv4: enabled: true dhcp: true bridge: options: stp: enabled: false port: - name: <physical_interface_name> # ...静的 IP アドレス指定を使用するネットワークおよび DHCP ネットワークなしの場合、NMState YAML ファイルを作成し、このファイルにベアメタルブリッジインターフェイスの詳細を指定します。

静的 IP アドレスを使用し、DHCP ネットワークを使用しないベアメタルブリッジインターフェイスの設定例

# ... dns-resolver: config: server: - <dns_ip_address> routes: config: - destination: 0.0.0.0/0 next-hop-interface: baremetal next-hop-address: <gateway_ip> interfaces: - name: <physical_interface_name> type: ethernet state: up ipv4: enabled: false ipv6: enabled: false - name: baremetal type: linux-bridge state: up ipv4: enabled: true dhcp: false address: - ip: <static_ip_address> prefix-length: 24 bridge: options: stp: enabled: false port: - name: <physical_interface_name> # ...ここでは、以下のようになります。

<dns-resolver>- ベアメタルシステムの DNS サーバーを定義します。

<server>-

&

lt;dns_ip_address> は DNS サーバーの IP アドレスに置き換えます。 <type>- ブリッジインターフェイスおよびその静的 IP 設定を定義します。

<gateway>-

<gateway_ip>をゲートウェイの IP アドレスに置き換えます。 <name>- ブリッジポートとして設定する物理インターフェイスについて詳しく説明します。

次のコマンドを入力して、YAML ファイルからホストのネットワークインターフェイスにネットワーク設定を適用します。

$ nmstatectl apply <path_to_network_yaml>次のコマンドを入力して、ネットワーク設定 YAML ファイルをバックアップします。

$ nmstatectl show > backup-nmstate.ymlオプション:クラスターをプロビジョニングネットワークにデプロイする場合は、NMState YAML ファイルを作成または編集し、ファイルに詳細を指定します。

注記IPv6 アドレスは、ベアメタルネットワークを介してルーティングしない任意のアドレスにすることができます。

IPv6 アドレスを使用する場合は、Unified Extensible Firmware Interface (UEFI)を有効にし、IPv6 プロトコルの UEFI PXE 設定を設定する。

プロビジョニングネットワークの NMState YAML ファイルの例

# ... interfaces: - name: eth1 type: ethernet state: up ipv4: enabled: false ipv6: enabled: false - name: provisioning type: linux-bridge state: up ipv4: enabled: true dhcp: false address: - ip: 172.22.0.254 prefix-length: 24 ipv6: enabled: true dhcp: false address: - ip: fd00:1101::1 prefix-length: 64 bridge: options: stp: enabled: false port: - name: eth1 # ...オプション:次のコマンドを実行して、

プロビジョナーノードに SSH 接続を確立します。# ssh kni@provisioner.<cluster_name>.<domain>以下は、

<cluster_name>.<domain>-

&

lt;cluster_name> はクラスターの名前に、<domain> はクラスターの完全修飾ドメイン名(FQDN)に置き換えます。

次のコマンドを実行して、接続ブリッジが適切に作成されたことを確認します。

$ sudo nmcli con show出力例

NAME UUID TYPE DEVICE baremetal 832f645a-9337-4afc-b48e-4a55c5779eab bridge baremetal provisioning e7756e01-d026-4a38-b460-129afaac0ec2 bridge provisioning Wired connection 1 49ff4c9c-db76-3139-8c18-c49fa7deb39a ethernet eth0 Wired connection 2 c1fb12b1-88a6-3c07-93b9-187c99204c43 ethernet eth1 lo aa030e0f-21ca-498f-b6ce-bac7d4d793f0 loopback lo

3.5. カスタマイズされた br-ex ブリッジを含むマニフェストオブジェクトの作成

configure-ovs.sh シェルスクリプトを使用してベアメタルプラットフォームで br-ex ブリッジを設定する代わりに、NMState 設定ファイルを含む MachineConfig オブジェクトを作成できます。ホスト nmstate-configuration.service および nmstate.service は、クラスターで実行される各ノードに NMState 設定ファイルを適用します。

configure-ovs.sh シェルスクリプトを使用してベアメタルプラットフォームで br-ex ブリッジを設定する代わりに、NMState 設定ファイルを含む NodeNetworkConfigurationPolicy (NNCP) カスタムリソース (CR) を作成することもできます。

Kubernetes NMState Operator がその NMState 設定ファイルを使用して、カスタマイズされた br-ex ブリッジネットワーク設定をクラスター内の各ノードに作成します。

NodeNetworkConfigurationPolicy CR を作成したら、クラスターのインストール中に作成された NMState 設定ファイルの内容を NNCP CR にコピーしてください。NNCP CR のファイルが不完全な場合、ファイルに記述されているネットワークポリシーをクラスター内のノードに適用できません。

この機能は、次のタスクをサポートします。

- クラスターの最大転送単位 (MTU) を変更します。

- MIImon (Media Independent Interface Monitor)、ボンディングモード、Quality of Service (QoS) などのさまざまなボンディングインターフェイスの属性を変更します。

- DNS 値を更新しています。

カスタマイズされた br-ex ブリッジを含むマニフェストオブジェクトを作成する場合は、次のユースケースを検討してください。

-

Open vSwitch (OVS) または OVN-Kubernetes

br-exブリッジネットワークの変更など、ブリッジにインストール後の変更を加えたい場合。configure-ovs.shシェルスクリプトは、ブリッジへのインストール後の変更をサポートしていません。 - ホストまたはサーバーの IP アドレスで使用可能なインターフェイスとは異なるインターフェイスにブリッジをデプロイします。

-

configure-ovs.shシェルスクリプトでは不可能な、ブリッジの高度な設定を実行したいと考えています。これらの設定にスクリプトを使用すると、ブリッジが複数のネットワークインターフェイスに接続できず、インターフェイス間のデータ転送が促進されない可能性があります。

単一のネットワークインターフェイスコントローラー (NIC) とデフォルトのネットワーク設定を備えた環境が必要な場合は、configure-ovs.sh シェルスクリプトを使用します。

Red Hat Enterprise Linux CoreOS (RHCOS) をインストールしてシステムを再起動すると、Machine Config Operator がクラスター内の各ノードに Ignition 設定ファイルを挿入し、各ノードが br-ex ブリッジネットワーク設定を受け取るようになります。設定の競合を防ぐために、configure-ovs.sh シェルスクリプトは、br-ex ブリッジを設定しない信号を受け取ります。

前提条件

-

オプション: NMState 設定を検証できるように、

nmstateAPI をインストールしました。

手順

カスタマイズされた

br-exブリッジネットワークの base64 情報をデコードした NMState 設定ファイルを作成します。カスタマイズされた

br-exブリッジネットワークの NMState 設定の例interfaces: - name: enp2s0 type: ethernet state: up ipv4: enabled: false ipv6: enabled: false - name: br-ex type: ovs-bridge state: up ipv4: enabled: false dhcp: false ipv6: enabled: false dhcp: false bridge: options: mcast-snooping-enable: true port: - name: enp2s0 - name: br-ex - name: br-ex type: ovs-interface state: up copy-mac-from: enp2s0 ipv4: enabled: true dhcp: true auto-route-metric: 48 ipv6: enabled: true dhcp: true auto-route-metric: 48 # ...ここでは、以下のようになります。

interfaces.name- インターフェイスの名前。

interfaces.type- イーサネットのタイプ。

interfaces.state- 作成後のインターフェイスの要求された状態。

ipv4.enabled- この例では、IPv4 と IPv6 を無効にします。

port.name- ブリッジが接続されるノードの NIC。

auto-route-metric-

br-exのデフォルトルートの優先順位が常に最も高い(最も低いメトリック)ようにするには、パラメーターを48に設定します。この設定により、NetworkManagerサービスが自動的に設定するその他のインターフェイスとのルーティングの競合が回避されます。

catコマンドを使用して、NMState 設定の内容を base64 でエンコードします。$ cat <nmstate_configuration>.yml | base64ここでは、以下のようになります。

<nmstate_configuration>-

<nmstate_configuration>を NMState リソース YAML ファイルの名前に置き換えます。

MachineConfigマニフェストファイルを作成し、次の例に類似したカスタマイズされたbr-exブリッジネットワーク設定を定義します。apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: worker name: 10-br-ex-worker spec: config: ignition: version: 3.2.0 storage: files: - contents: source: data:text/plain;charset=utf-8;base64,<base64_encoded_nmstate_configuration> mode: 0644 overwrite: true path: /etc/nmstate/openshift/worker-0.yml - contents: source: data:text/plain;charset=utf-8;base64,<base64_encoded_nmstate_configuration> mode: 0644 overwrite: true path: /etc/nmstate/openshift/worker-1.yml # ...ここでは、以下のようになります。

metadata.name- ポリシーの名前。

contents.source- エンコードされた base64 情報を指定されたパスに書き込みます。

pathクラスター内の各ノードに対して、ノードへのホスト名パスと、マシンタイプに応じた base-64 でエンコードされた Ignition 設定ファイルデータを指定します。

workerロールは、クラスター内のノードのデフォルトロールです。各ノードまたはMachineConfigマニフェストファイルのすべてのノードに短いホスト名パスを指定する場合は、$(hostname -s)などの設定ファイルに .yml 拡張を使用する必要があります。.yml/etc/nmstate/openshift/cluster.yml設定ファイルで、クラスター内のすべてのノードに適用する単一のグローバル設定が指定されている場合は、/etc/nmstate/openshift/<node_hostname>.ymlなどの各ノードの短いホスト名パスを指定する必要はありません。以下に例を示します。# ... - contents: source: data:text/plain;charset=utf-8;base64,<base64_encoded_nmstate_configuration> mode: 0644 overwrite: true path: /etc/nmstate/openshift/cluster.yml # ...

次のコマンドを入力して、

MachineConfigオブジェクトからの更新をクラスターに適用します。$ oc apply -f <machine_config>.yml

次のステップ

-

コンピュートノードをスケーリングして、クラスター内に存在する各コンピュートノードに、カスタマイズされた

br-exブリッジを含むマニフェストオブジェクトを適用します。詳細は、関連情報 セクションの「クラスターの拡張」を参照してください。

3.5.1. オプション: 各マシンセットをコンピュートノードにスケーリングする

カスタマイズされた br-ex ブリッジ設定を OpenShift Container Platform クラスター内のすべてのコンピュートノードに適用するには、MachineConfig カスタムリソース (CR) を編集し、そのロールを変更する必要があります。さらに、ホスト名、認証情報など、ベアメタルマシンの情報を定義する BareMetalHost CR を作成する必要があります。

これらのリソースを設定した後、マシンセットをスケーリングして、マシンセットが各コンピュートノードにリソース設定を適用し、ノードを再起動できるようにする必要があります。

前提条件

-

カスタマイズされた

br-exブリッジ設定を含むMachineConfigマニフェストオブジェクトを作成しました。

手順

次のコマンドを入力して

MachineConfigCR を編集します。$ oc edit mc <machineconfig_custom_resource_name>- 各コンピュートノード設定を CR に追加して、CR がクラスター内の定義済みコンピュートノードごとにロールを管理できるようにします。

-

最小限の静的 IP 設定を持つ

extraworker-secretという名前のSecretオブジェクトを作成します。 次のコマンドを入力して、クラスター内の各ノードに

extraworker-secretシークレットを適用します。このステップでは、各コンピュートノードに Ignition 設定ファイルへのアクセスを提供します。$ oc apply -f ./extraworker-secret.yamlBareMetalHostリソースを作成し、preprovisioningNetworkDataNameパラメーターでネットワークシークレットを指定します。ネットワークシークレットが添付された

BareMetalHostリソースの例apiVersion: metal3.io/v1alpha1 kind: BareMetalHost spec: # ... preprovisioningNetworkDataName: ostest-extraworker-0-network-config-secret # ...クラスターの

openshift-machine-apinamespace 内でBareMetalHostオブジェクトを管理するために、次のコマンドを入力して namespace に変更します。$ oc project openshift-machine-apiマシンセットを取得します。

$ oc get machinesets次のコマンドを入力して、各マシンセットをスケールします。このコマンドはマシンセットごとに実行する必要があります。

$ oc scale machineset <machineset_name> --replicas=<n>1 - 1

<machineset_name>はマシンセットの名前です。<n>はコンピュートノードの数です。

3.6. クラスターで OVS balance-slb モードを有効にする

Open vSwitch (OVS)の balance-slb モードを有効にして、2 つ以上の物理インターフェイスがネットワークトラフィックを共有できるようにすることができます。Balance -slb モードインターフェイスは、ネットワークスイッチとの負荷分散を必要とせずに、仮想化ワークロードを実行するクラスターにソース負荷分散(SLB)機能を提供することができます。

現在、ソース負荷分散はボンドインターフェイスで実行され、このインターフェイスは br-phy などの補助ブリッジに接続します。ソースの負荷分散は、異なる Media Access Control (MAC)アドレスと仮想ローカルエリアネットワーク(VLAN)の組み合わせでのみ分散されます。すべての OVN-Kubernetes Pod トラフィックは同じ MAC アドレスと VLAN を使用するため、このトラフィックは多くの物理インターフェイス間で負荷分散できないことに注意してください。

次の図は、単純なクラスターインフラストラクチャーレイアウトでの balance-slb モードを示しています。仮想マシン (VM) は、特定の localnet NetworkAttachmentDefinition (NAD) カスタムリソース定義 (CRD)、NAD 0 または NAD 1 に接続します。各 NAD は、VLAN タグ付きまたはタグなしのトラフィックをサポートする基盤となる物理ネットワークにアクセスできるように、VM を提供します。br-ex OVS ブリッジは仮想マシンからのトラフィックを受信し、そのトラフィックを次の OVS ブリッジである br-phy に渡します。br-phy ブリッジは SLB ボンディングのコントローラーとして機能します。SLB ボンディングは、eno0 や eno1 などの物理インターフェイスリンクを介して、異なる仮想マシンポートからのトラフィックを分散します。さらに、どちらの物理インターフェイスからの Ingress トラフィックも、OVS ブリッジのセットを通過して仮想マシンに到達できます。

図3.1 2 つの NAD CRD を持つ localnet で動作する OVS balance-slb モード

OVS ボンディングを使用して、balance-slb モードインターフェイスをプライマリーまたはセカンダリーネットワークタイプに統合できます。OVS ボンディングでは、次の点に注意してください。

- OVN-Kubernetes CNI プラグインをサポートし、プラグインと簡単に統合できます。

-

ネイティブで

balance-slbモードをサポートします。

前提条件

-

プライマリーネットワークに複数の物理インターフェイスが接続されており、それらのインターフェイスを

MachineConfigファイルで定義している。 -

マニフェストオブジェクトを作成し、オブジェクト設定ファイルでカスタマイズされた

br-exブリッジを定義している。 - プライマリーネットワークに複数の物理インターフェイスが割り当てられ、NAD CRD ファイルでインターフェイスを定義している。

手順

クラスター内に存在するベアメタルホストごとに、クラスターの

install-config.yamlファイルで、次の例のようにnetworkConfigセクションを定義します。apiVersion: v1 kind: InstallConfig metadata: name: <cluster-name> # ... networkConfig: interfaces: - name: enp1s01 type: ethernet state: up ipv4: dhcp: true enabled: true ipv6: enabled: false - name: enp2s02 type: ethernet state: up mtu: 15003 ipv4: dhcp: true enabled: true ipv6: dhcp: true enabled: true - name: enp3s04 type: ethernet state: up mtu: 1500 ipv4: enabled: false ipv6: enabled: false # ...NMState 設定ファイルで各ネットワークインターフェイスを定義します。

多くのネットワークインターフェイスを定義する NMState 設定ファイルの例

apiVersion: nmstate.io/v1 kind: NodeNetworkConfigurationPolicy metadata: # ... ovn: bridge-mappings: - localnet: localnet-network bridge: br-ex state: present interfaces: - name: br-ex type: ovs-bridge state: up bridge: allow-extra-patch-ports: true port: - name: br-ex - name: patch-ex-to-phy ovs-db: external_ids: bridge-uplink: "patch-ex-to-phy" - name: br-ex type: ovs-interface state: up mtu: 15001 ipv4: enabled: true dhcp: true auto-route-metric: 48 ipv6: enabled: false dhcp: false auto-route-metric: 48 - name: br-phy type: ovs-bridge state: up bridge: allow-extra-patch-ports: true port: - name: patch-phy-to-ex - name: ovs-bond link-aggregation: mode: balance-slb port: - name: enp2s0 - name: enp3s0 - name: patch-ex-to-phy type: ovs-interface state: up patch: peer: patch-phy-to-ex - name: patch-phy-to-ex type: ovs-interface state: up patch: peer: patch-ex-to-phy - name: enp1s0 type: ethernet state: up ipv4: dhcp: true enabled: true ipv6: enabled: false - name: enp2s0 type: ethernet state: up mtu: 1500 ipv4: enabled: false ipv6: enabled: false - name: enp3s0 type: ethernet state: up mtu: 1500 ipv4: enabled: false ipv6: enabled: false # ...- 1

- ボンディングポートで

br-exMTU を手動で設定します。

base64コマンドを使用して、NMState 設定ファイルのインターフェイスコンテンツをエンコードします。$ base64 -w0 <nmstate_configuration>.yml1 - 1

-w0オプションは、base64 エンコード操作中に行の折り返しを防止します。

masterロールとworkerロールのMachineConfigマニフェストファイルを作成します。前のコマンドの base64 でエンコードされた文字列を各MachineConfigマニフェストファイルに埋め込むようにしてください。次のマニフェストファイルの例では、クラスター内に存在するすべてのノードに対してmasterロールを設定します。ノード固有のmasterロールとworkerロールのマニフェストファイルを作成することもできます。apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: master name: 10-br-ex-master1 spec: config: ignition: version: 3.2.0 storage: files: - contents: source: data:text/plain;charset=utf-8;base64,<base64_encoded_nmstate_configuration>2 mode: 0644 overwrite: true path: /etc/nmstate/openshift/cluster.yml3 各

MachineConfigマニフェストファイルを./<installation_directory>/manifests ディレクトリーに保存します。ここで、<installation_directory> は、インストールプログラムがファイルを作成するディレクトリーに移動します。Machine Config Operator (MCO)は各マニフェストファイルからコンテンツを取得し、ローリング更新中に選択されたすべてのノードにコンテンツを一貫して適用します。

3.7. サブネット間の通信を確立する

一般的な OpenShift Container Platform クラスターのセットアップでは、コントロールプレーンとコンピュートノードを含むすべてのノードが同じネットワーク内に存在します。ただし、エッジコンピューティングのシナリオでは、コンピュートノードをエッジの近くに配置することが有益な場合があります。その場合、コントロールプレーンやローカルコンピュートノードが使用するサブネットとは異なるネットワークセグメントまたはサブネットをリモートノードに使用することもよくあります。このようなセットアップにより、エッジのレイテンシーが減少し、拡張性が向上します。

OpenShift Container Platform をインストールする前に、リモートノードを含むエッジサブネットがコントロールプレーンノードを含むサブネットに到達し、コントロールプレーンからのトラフィックも受信できるように、ネットワークを適切に設定する必要があります。

クラスターのインストール中に、install-config.yaml 設定ファイルのネットワーク設定でノードに永続的な IP アドレスを割り当てます。これを行わないと、ノードに一時的な IP アドレスが割り当てられ、トラフィックがノードに到達する方法に影響する可能性があります。たとえば、ノードに一時的な IP アドレスが割り当てられていて、ノードに対して結合されたインターフェイスを設定した場合、結合されたインターフェイスは別の IP アドレスを受け取る可能性があります。

デフォルトのロードバランサーの代わりにユーザー管理のロードバランサーを設定することで、同じサブネットまたは複数のサブネットでコントロールプレーンノードを実行できます。複数のサブネット環境を使用すると、ハードウェア障害やネットワーク停止によって OpenShift Container Platform クラスターが失敗するリスクを軽減できます。詳細は、「ユーザー管理ロードバランサーのサービス」および「ユーザー管理ロードバランサーの設定」を参照してください。

複数のサブネット環境でコントロールプレーンノードを実行するには、次の主要なタスクを完了する必要があります。

-

install-config.yamlファイルのloadBalancer.typeパラメーターでUserManagedを指定して、デフォルトのロードバランサーの代わりにユーザー管理のロードバランサーを設定します。 -

install-config.yamlファイルのingressVIPsおよびapiVIPsパラメーターでユーザー管理のロードバランサーのアドレスを設定します。 -

複数のサブネットの Classless Inter-Domain Routing (CIDR) とユーザー管理のロードバランサーの IP アドレスを、

install-config.yamlファイルのnetworking.machineNetworksパラメーターに追加します。

複数のサブネットを持つクラスターをデプロイするには、redfish-virtualmedia や idrac-virtualmedia などの仮想メディアを使用する必要があります。

この手順では、2 番目のサブネットにあるリモートコンピュートノードが 1 番目のサブネットにあるコントロールプレーンノードと効果的に通信できるようにするために必要なネットワーク設定と、1 番目のサブネットにあるコントロールプレーンノードが 2 番目のサブネットにあるリモートコンピュートノードと効果的に通信できるようにするために必要なネットワーク設定を詳しく説明します。

この手順では、クラスターは 2 つのサブネットにまたがります。

-

1 番目のサブネット (

10.0.0.0) には、コントロールプレーンとローカルコンピュートノードが含まれています。 -

2 番目のサブネット (

192.168.0.0) には、エッジコンピュートノードが含まれています。

手順

1 番目のサブネットが 2 番目のサブネットと通信するように設定します。

次のコマンドを実行して、コントロールプレーンノードに

rootとしてログインします。$ sudo su -次のコマンドを実行して、ネットワークインターフェイスの名前を取得します。

# nmcli dev status次のコマンドを実行して、ゲートウェイを経由する 2 番目のサブネット (

192.168.0.0) へのルートを追加します。# nmcli connection modify <interface_name> +ipv4.routes "192.168.0.0/24 via <gateway>"<interface_name>をインターフェイス名に置き換えます。<gateway>を実際のゲートウェイの IP アドレスに置き換えます。例

# nmcli connection modify eth0 +ipv4.routes "192.168.0.0/24 via 192.168.0.1"次のコマンドを実行して変更を適用します。

# nmcli connection up <interface_name><interface_name>をインターフェイス名に置き換えます。ルーティングテーブルを検証して、ルートが正常に追加されたことを確認します。

# ip route1 番目のサブネットの各コントロールプレーンノードに対して前の手順を繰り返します。

注記コマンドは、実際のインターフェイス名とゲートウェイに合わせて調整してください。

1 番目のサブネットと通信するように 2 番目のサブネットを設定します。

次のコマンドを実行して、リモートコンピュートノードに

rootとしてログインします。$ sudo su -次のコマンドを実行して、ネットワークインターフェイスの名前を取得します。

# nmcli dev status次のコマンドを実行して、ゲートウェイを経由する最初のサブネット (

10.0.0.0) へのルートを追加します。# nmcli connection modify <interface_name> +ipv4.routes "10.0.0.0/24 via <gateway>"<interface_name>をインターフェイス名に置き換えます。<gateway>を実際のゲートウェイの IP アドレスに置き換えます。例

# nmcli connection modify eth0 +ipv4.routes "10.0.0.0/24 via 10.0.0.1"次のコマンドを実行して変更を適用します。

# nmcli connection up <interface_name><interface_name>をインターフェイス名に置き換えます。次のコマンドを実行して、ルーティングテーブルを検証し、ルートが正常に追加されたことを確認します。

# ip route2 番目のサブネット内の各コンピュートノードに対して、上記の手順を繰り返します。

注記コマンドは、実際のインターフェイス名とゲートウェイに合わせて調整してください。

ネットワークを設定したら、接続をテストして、リモートノードがコントロールプレーンノードに到達できること、およびコントロールプレーンノードがリモートノードに到達できることを確認します。

1 番目のサブネットのコントロールプレーンノードから、次のコマンドを実行して、2 番目のサブネットのリモートノードに ping を実行します。

$ ping <remote_node_ip_address>ping が成功した場合は、1 番目のサブネットのコントロールプレーンノードが 2 番目のサブネットのリモートノードに到達できています。応答がない場合は、ネットワーク設定を確認し、ノードに対して手順を繰り返します。

2 番目のサブネットのリモートノードから、次のコマンドを実行して、1 番目のサブネットのコントロールプレーンノードに ping を実行します。

$ ping <control_plane_node_ip_address>ping が成功した場合は、2 番目のサブネットのリモートコンピュートノードが 1 番目のサブネットのコントロールプレーンに到達できています。応答がない場合は、ネットワーク設定を確認し、ノードに対して手順を繰り返します。

3.8. OpenShift Container Platform インストーラーの取得

インストールプログラムの stable-4.x バージョンと選択したアーキテクチャーを使用して、OpenShift Container Platform の一般公開の安定バージョンをデプロイします。

$ export VERSION=stable-4.16$ export RELEASE_ARCH=<architecture>$ export RELEASE_IMAGE=$(curl -s https://mirror.openshift.com/pub/openshift-v4/$RELEASE_ARCH/clients/ocp/$VERSION/release.txt | grep 'Pull From: quay.io' | awk -F ' ' '{print $3}')3.9. OpenShift Container Platform インストールのデプロイメント

インストーラーを取得したら、インストーラーを展開します。

手順

環境変数を設定します。

$ export cmd=openshift-baremetal-install$ export pullsecret_file=~/pull-secret.txt$ export extract_dir=$(pwd)ocバイナリーを取得します。$ curl -s https://mirror.openshift.com/pub/openshift-v4/clients/ocp/$VERSION/openshift-client-linux.tar.gz | tar zxvf - ocインストーラーを実行します。

$ sudo cp oc /usr/local/bin$ oc adm release extract --registry-config "${pullsecret_file}" --command=$cmd --to "${extract_dir}" ${RELEASE_IMAGE}$ sudo cp openshift-baremetal-install /usr/local/bin

3.10. オプション: RHCOS イメージキャッシュの作成

イメージキャッシングを使用するには、ブートストラップ VM がクラスターノードをプロビジョニングするために使用する Red Hat Enterprise Linux CoreOS(RHCOS) イメージをダウンロードする必要があります。イメージのキャッシュはオプションですが、帯域幅が制限されているネットワークでインストールプログラムを実行する場合に特に便利です。

正しいイメージがリリースペイロードにあるため、インストールプログラムは、clusterOSImage RHCOS イメージを必要としなくなりました。

帯域幅が制限されたネットワークでインストールプログラムを実行していて、RHCOS イメージのダウンロードに 15〜20 分以上かかる場合、インストールプログラムはタイムアウトになります。このような場合、Web サーバーでイメージをキャッシュすることができます。

HTTPD サーバーに対して TLS を有効にする場合、ルート証明書がクライアントによって信頼された機関によって署名されていることを確認し、OpenShift Container Platform ハブおよびスポーククラスターと HTTPD サーバー間の信頼された証明書チェーンを検証する必要があります。信頼されていない証明書で設定されたサーバーを使用すると、イメージがイメージ作成サービスにダウンロードされなくなります。信頼されていない HTTPS サーバーの使用はサポートされていません。

イメージを含むコンテナーをインストールします。

手順

podmanをインストールします。$ sudo dnf install -y podmanRHCOS イメージのキャッシュに使用されるファイアウォールのポート

8080を開きます。$ sudo firewall-cmd --add-port=8080/tcp --zone=public --permanent$ sudo firewall-cmd --reloadbootstraposimageを保存するディレクトリーを作成します。$ mkdir /home/kni/rhcos_image_cache新規に作成されたディレクトリーに適切な SELinux コンテキストを設定します。

$ sudo semanage fcontext -a -t httpd_sys_content_t "/home/kni/rhcos_image_cache(/.*)?"$ sudo restorecon -Rv /home/kni/rhcos_image_cache/インストールプログラムがブートストラップ VM にデプロイする RHCOS イメージの URI を取得します。

$ export RHCOS_QEMU_URI=$(/usr/local/bin/openshift-baremetal-install coreos print-stream-json | jq -r --arg ARCH "$(arch)" '.architectures[$ARCH].artifacts.qemu.formats["qcow2.gz"].disk.location')インストールプログラムがブートストラップ VM にデプロイするイメージの名前を取得します。

$ export RHCOS_QEMU_NAME=${RHCOS_QEMU_URI##*/}ブートストラップ仮想マシンにデプロイされる RHCOS イメージの SHA ハッシュを取得します。

$ export RHCOS_QEMU_UNCOMPRESSED_SHA256=$(/usr/local/bin/openshift-baremetal-install coreos print-stream-json | jq -r --arg ARCH "$(arch)" '.architectures[$ARCH].artifacts.qemu.formats["qcow2.gz"].disk["uncompressed-sha256"]')イメージをダウンロードして、

/home/kni/rhcos_image_cacheディレクトリーに配置します。$ curl -L ${RHCOS_QEMU_URI} -o /home/kni/rhcos_image_cache/${RHCOS_QEMU_NAME}新しいファイルの SELinux タイプが

httpd_sys_content_tであることを確認します。$ ls -Z /home/kni/rhcos_image_cachePod を作成します。

$ podman run -d --name rhcos_image_cache \1 -v /home/kni/rhcos_image_cache:/var/www/html \ -p 8080:8080/tcp \ registry.access.redhat.com/ubi9/httpd-24- 1

rhcos_image_cacheという名前のキャッシング Web サーバーを作成します。この Pod は、デプロイメント用にinstall-config.yamlファイルのbootstrapOSImageイメージを提供します。

bootstrapOSImage設定を生成します。$ export BAREMETAL_IP=$(ip addr show dev baremetal | awk '/inet /{print $2}' | cut -d"/" -f1)$ export BOOTSTRAP_OS_IMAGE="http://${BAREMETAL_IP}:8080/${RHCOS_QEMU_NAME}?sha256=${RHCOS_QEMU_UNCOMPRESSED_SHA256}"$ echo " bootstrapOSImage=${BOOTSTRAP_OS_IMAGE}"platform.baremetal下のinstall-config.yamlファイルに必要な設定を追加します。platform: baremetal: bootstrapOSImage: <bootstrap_os_image>1 - 1

<bootstrap_os_image>を$BOOTSTRAP_OS_IMAGEの値に置き換えます。

詳細は、「install-config.yaml ファイルの設定」セクションを参照してください。

3.11. ユーザー管理ロードバランサーのサービス

デフォルトのロードバランサーの代わりに、ユーザーが管理するロードバランサーを使用するように OpenShift Container Platform クラスターを設定できます。

ユーザー管理ロードバランサーの設定は、ベンダーのロードバランサーによって異なります。

このセクションの情報と例は、ガイドラインのみを目的としています。ベンダーのロードバランサーに関する詳細は、ベンダーのドキュメントを参照してください。

Red Hat は、ユーザー管理ロードバランサーに対して次のサービスをサポートしています。

- Ingress Controller

- OpenShift API

- OpenShift MachineConfig API

ユーザー管理ロードバランサーに対して、これらのサービスの 1 つを設定するか、すべてを設定するかを選択できます。一般的な設定オプションは、Ingress Controller サービスのみを設定することです。次の図は、各サービスの詳細を示しています。

図3.2 OpenShift Container Platform 環境で動作する Ingress Controller を示すネットワークワークフローの例

図3.3 OpenShift Container Platform 環境で動作する OpenShift API を示すネットワークワークフローの例

図3.4 OpenShift Container Platform 環境で動作する OpenShift MachineConfig API を示すネットワークワークフローの例

ユーザー管理ロードバランサーでは、次の設定オプションがサポートされています。

- ノードセレクターを使用して、Ingress Controller を特定のノードのセットにマッピングします。このセットの各ノードに静的 IP アドレスを割り当てるか、Dynamic Host Configuration Protocol (DHCP) から同じ IP アドレスを受け取るように各ノードを設定する必要があります。インフラストラクチャーノードは通常、このタイプの設定を受け取ります。

サブネット上のすべての IP アドレスをターゲットにします。この設定では、ロードバランサーターゲットを再設定せずにネットワーク内でノードを作成および破棄できるため、メンテナンスオーバーヘッドを削減できます。

/27や/28などの小規模なネットワーク上に設定されたマシンを使用して Ingress Pod をデプロイする場合、ロードバランサーのターゲットを簡素化できます。ヒントマシン config プールのリソースを確認することで、ネットワーク内に存在するすべての IP アドレスをリスト表示できます。

OpenShift Container Platform クラスターのユーザー管理ロードバランサーを設定する前に、以下の情報を考慮してください。

- フロントエンド IP アドレスの場合、フロントエンド IP アドレス、Ingress Controller のロードバランサー、および API ロードバランサーに同じ IP アドレスを使用できます。この機能は、ベンダーのドキュメントを確認してください。

バックエンド IP アドレスの場合、ユーザー管理ロードバランサーの有効期間中に OpenShift Container Platform コントロールプレーンノードの IP アドレスが変更されないことを確認します。次のいずれかのアクションを実行すると、これを実現できます。

- 各コントロールプレーンノードに静的 IP アドレスを割り当てます。

- ノードが DHCP リースを要求するたびに、DHCP から同じ IP アドレスを受信するように各ノードを設定します。ベンダーによっては、DHCP リースは IP 予約または静的 DHCP 割り当ての形式になる場合があります。

- Ingress Controller バックエンドサービスのユーザー管理ロードバランサーで Ingress Controller を実行する各ノードを手動で定義します。たとえば、Ingress Controller が未定義のノードに移動すると、接続が停止する可能性があります。

3.11.1. ユーザー管理ロードバランサーの設定

デフォルトのロードバランサーの代わりに、ユーザーが管理するロードバランサーを使用するように OpenShift Container Platform クラスターを設定できます。

ユーザー管理ロードバランサーを設定する前に、「ユーザー管理ロードバランサーのサービス」セクションを必ずお読みください。

ユーザー管理ロードバランサー用に設定するサービスに適用される次の前提条件をお読みください。

クラスター上で実行される MetalLB は、ユーザー管理ロードバランサーとして機能します。

OpenShift API の前提条件

- フロントエンド IP アドレスを定義している。

TCP ポート 6443 および 22623 は、ロードバランサーのフロントエンド IP アドレスで公開されている。以下の項目を確認します。

- ポート 6443 が OpenShift API サービスにアクセスできる。

- ポート 22623 が Ignition 起動設定をノードに提供できる。

- フロントエンド IP アドレスとポート 6443 へは、OpenShift Container Platform クラスターの外部の場所にいるシステムのすべてのユーザーがアクセスできる。

- フロントエンド IP アドレスとポート 22623 は、OpenShift Container Platform ノードからのみ到達できる。

- ロードバランサーバックエンドは、ポート 6443 および 22623 の OpenShift Container Platform コントロールプレーンノードと通信できる。

Ingress Controller の前提条件

- フロントエンド IP アドレスを定義している。

- TCP ポート 443 および 80 はロードバランサーのフロントエンド IP アドレスで公開されている。

- フロントエンドの IP アドレス、ポート 80、ポート 443 へは、OpenShift Container Platform クラスターの外部の場所にあるシステムの全ユーザーがアクセスできる。

- フロントエンドの IP アドレス、ポート 80、ポート 443 は、OpenShift Container Platform クラスターで動作するすべてのノードから到達できる。

- ロードバランサーバックエンドは、ポート 80、443、および 1936 で Ingress Controller を実行する OpenShift Container Platform ノードと通信できる。

ヘルスチェック URL 仕様の前提条件

ほとんどのロードバランサーは、サービスが使用可能か使用不可かを判断するヘルスチェック URL を指定して設定できます。OpenShift Container Platform は、OpenShift API、Machine Configuration API、および Ingress Controller バックエンドサービスのこれらのヘルスチェックを提供します。

次の例は、前にリスト表示したバックエンドサービスのヘルスチェック仕様を示しています。

Kubernetes API ヘルスチェック仕様の例

Path: HTTPS:6443/readyz

Healthy threshold: 2

Unhealthy threshold: 2

Timeout: 10

Interval: 10Machine Config API ヘルスチェック仕様の例

Path: HTTPS:22623/healthz

Healthy threshold: 2

Unhealthy threshold: 2

Timeout: 10

Interval: 10Ingress Controller のヘルスチェック仕様の例

Path: HTTP:1936/healthz/ready

Healthy threshold: 2

Unhealthy threshold: 2

Timeout: 5

Interval: 10手順

HAProxy Ingress Controller を設定して、ポート 6443、22623、443、および 80 でロードバランサーからクラスターへのアクセスを有効化できるようにします。必要に応じて、HAProxy 設定で単一のサブネットの IP アドレスまたは複数のサブネットの IP アドレスを指定できます。

1 つのサブネットをリストした HAProxy 設定の例

# ... listen my-cluster-api-6443 bind 192.168.1.100:6443 mode tcp balance roundrobin option httpchk http-check connect http-check send meth GET uri /readyz http-check expect status 200 server my-cluster-master-2 192.168.1.101:6443 check inter 10s rise 2 fall 2 server my-cluster-master-0 192.168.1.102:6443 check inter 10s rise 2 fall 2 server my-cluster-master-1 192.168.1.103:6443 check inter 10s rise 2 fall 2 listen my-cluster-machine-config-api-22623 bind 192.168.1.100:22623 mode tcp balance roundrobin option httpchk http-check connect http-check send meth GET uri /healthz http-check expect status 200 server my-cluster-master-2 192.168.1.101:22623 check inter 10s rise 2 fall 2 server my-cluster-master-0 192.168.1.102:22623 check inter 10s rise 2 fall 2 server my-cluster-master-1 192.168.1.103:22623 check inter 10s rise 2 fall 2 listen my-cluster-apps-443 bind 192.168.1.100:443 mode tcp balance roundrobin option httpchk http-check connect http-check send meth GET uri /healthz/ready http-check expect status 200 server my-cluster-worker-0 192.168.1.111:443 check port 1936 inter 10s rise 2 fall 2 server my-cluster-worker-1 192.168.1.112:443 check port 1936 inter 10s rise 2 fall 2 server my-cluster-worker-2 192.168.1.113:443 check port 1936 inter 10s rise 2 fall 2 listen my-cluster-apps-80 bind 192.168.1.100:80 mode tcp balance roundrobin option httpchk http-check connect http-check send meth GET uri /healthz/ready http-check expect status 200 server my-cluster-worker-0 192.168.1.111:80 check port 1936 inter 10s rise 2 fall 2 server my-cluster-worker-1 192.168.1.112:80 check port 1936 inter 10s rise 2 fall 2 server my-cluster-worker-2 192.168.1.113:80 check port 1936 inter 10s rise 2 fall 2 # ...複数のサブネットをリストした HAProxy 設定の例

# ... listen api-server-6443 bind *:6443 mode tcp server master-00 192.168.83.89:6443 check inter 1s server master-01 192.168.84.90:6443 check inter 1s server master-02 192.168.85.99:6443 check inter 1s server bootstrap 192.168.80.89:6443 check inter 1s listen machine-config-server-22623 bind *:22623 mode tcp server master-00 192.168.83.89:22623 check inter 1s server master-01 192.168.84.90:22623 check inter 1s server master-02 192.168.85.99:22623 check inter 1s server bootstrap 192.168.80.89:22623 check inter 1s listen ingress-router-80 bind *:80 mode tcp balance source server worker-00 192.168.83.100:80 check inter 1s server worker-01 192.168.83.101:80 check inter 1s listen ingress-router-443 bind *:443 mode tcp balance source server worker-00 192.168.83.100:443 check inter 1s server worker-01 192.168.83.101:443 check inter 1s listen ironic-api-6385 bind *:6385 mode tcp balance source server master-00 192.168.83.89:6385 check inter 1s server master-01 192.168.84.90:6385 check inter 1s server master-02 192.168.85.99:6385 check inter 1s server bootstrap 192.168.80.89:6385 check inter 1s listen inspector-api-5050 bind *:5050 mode tcp balance source server master-00 192.168.83.89:5050 check inter 1s server master-01 192.168.84.90:5050 check inter 1s server master-02 192.168.85.99:5050 check inter 1s server bootstrap 192.168.80.89:5050 check inter 1s # ...curlCLI コマンドを使用して、ユーザー管理ロードバランサーとそのリソースが動作していることを確認します。次のコマンドを実行して応答を観察し、クラスターマシン設定 API が Kubernetes API サーバーリソースにアクセスできることを確認します。

$ curl https://<loadbalancer_ip_address>:6443/version --insecure設定が正しい場合は、応答として JSON オブジェクトを受信します。

{ "major": "1", "minor": "11+", "gitVersion": "v1.11.0+ad103ed", "gitCommit": "ad103ed", "gitTreeState": "clean", "buildDate": "2019-01-09T06:44:10Z", "goVersion": "go1.10.3", "compiler": "gc", "platform": "linux/amd64" }次のコマンドを実行して出力を確認し、クラスターマシン設定 API がマシン設定サーバーリソースからアクセスできることを確認します。

$ curl -v https://<loadbalancer_ip_address>:22623/healthz --insecure設定が正しい場合、コマンドの出力には次の応答が表示されます。

HTTP/1.1 200 OK Content-Length: 0次のコマンドを実行して出力を確認し、コントローラーがポート 80 の Ingress Controller リソースにアクセスできることを確認します。

$ curl -I -L -H "Host: console-openshift-console.apps.<cluster_name>.<base_domain>" http://<load_balancer_front_end_IP_address>設定が正しい場合、コマンドの出力には次の応答が表示されます。

HTTP/1.1 302 Found content-length: 0 location: https://console-openshift-console.apps.ocp4.private.opequon.net/ cache-control: no-cache次のコマンドを実行して出力を確認し、コントローラーがポート 443 の Ingress Controller リソースにアクセスできることを確認します。

$ curl -I -L --insecure --resolve console-openshift-console.apps.<cluster_name>.<base_domain>:443:<Load Balancer Front End IP Address> https://console-openshift-console.apps.<cluster_name>.<base_domain>設定が正しい場合、コマンドの出力には次の応答が表示されます。

HTTP/1.1 200 OK referrer-policy: strict-origin-when-cross-origin set-cookie: csrf-token=UlYWOyQ62LWjw2h003xtYSKlh1a0Py2hhctw0WmV2YEdhJjFyQwWcGBsja261dGLgaYO0nxzVErhiXt6QepA7g==; Path=/; Secure; SameSite=Lax x-content-type-options: nosniff x-dns-prefetch-control: off x-frame-options: DENY x-xss-protection: 1; mode=block date: Wed, 04 Oct 2023 16:29:38 GMT content-type: text/html; charset=utf-8 set-cookie: 1e2670d92730b515ce3a1bb65da45062=1bf5e9573c9a2760c964ed1659cc1673; path=/; HttpOnly; Secure; SameSite=None cache-control: private

ユーザー管理ロードバランサーのフロントエンド IP アドレスをターゲットにするようにクラスターの DNS レコードを設定します。ロードバランサー経由で、クラスター API およびアプリケーションの DNS サーバーのレコードを更新する必要があります。

変更された DNS レコードの例

<load_balancer_ip_address> A api.<cluster_name>.<base_domain> A record pointing to Load Balancer Front End<load_balancer_ip_address> A apps.<cluster_name>.<base_domain> A record pointing to Load Balancer Front End重要DNS の伝播では、各 DNS レコードが使用可能になるまでに時間がかかる場合があります。各レコードを検証する前に、各 DNS レコードが伝播されることを確認してください。

OpenShift Container Platform クラスターでユーザー管理ロードバランサーを使用するには、クラスターの

install-config.yamlファイルで次の設定を指定する必要があります。# ... platform: baremetal: loadBalancer: type: UserManaged1 apiVIPs: - <api_ip>2 ingressVIPs: - <ingress_ip>3 # ...- 1

- クラスターのユーザー管理ロードバランサーを指定するには、

typeパラメーターにUserManagedを設定します。パラメーターのデフォルトはOpenShiftManagedDefaultで、これはデフォルトの内部ロードバランサーを示します。openshift-kni-infranamespace で定義されたサービスの場合、ユーザー管理ロードバランサーはcorednsサービスをクラスター内の Pod にデプロイできますが、keepalivedおよびhaproxyサービスは無視します。 - 2

- ユーザー管理ロードバランサーを指定する場合に必須のパラメーターです。Kubernetes API がユーザー管理ロードバランサーと通信できるように、ユーザー管理ロードバランサーのパブリック IP アドレスを指定します。

- 3

- ユーザー管理ロードバランサーを指定する場合に必須のパラメーターです。ユーザー管理ロードバランサーのパブリック IP アドレスを指定して、ユーザー管理ロードバランサーがクラスターの Ingress トラフィックを管理できるようにします。

検証

curlCLI コマンドを使用して、ユーザー管理ロードバランサーと DNS レコード設定が動作していることを確認します。次のコマンドを実行して出力を確認し、クラスター API にアクセスできることを確認します。

$ curl https://api.<cluster_name>.<base_domain>:6443/version --insecure設定が正しい場合は、応答として JSON オブジェクトを受信します。

{ "major": "1", "minor": "11+", "gitVersion": "v1.11.0+ad103ed", "gitCommit": "ad103ed", "gitTreeState": "clean", "buildDate": "2019-01-09T06:44:10Z", "goVersion": "go1.10.3", "compiler": "gc", "platform": "linux/amd64" }次のコマンドを実行して出力を確認し、クラスターマシン設定にアクセスできることを確認します。

$ curl -v https://api.<cluster_name>.<base_domain>:22623/healthz --insecure設定が正しい場合、コマンドの出力には次の応答が表示されます。

HTTP/1.1 200 OK Content-Length: 0以下のコマンドを実行して出力を確認し、ポートで各クラスターアプリケーションにアクセスできることを確認します。

$ curl http://console-openshift-console.apps.<cluster_name>.<base_domain> -I -L --insecure設定が正しい場合、コマンドの出力には次の応答が表示されます。

HTTP/1.1 302 Found content-length: 0 location: https://console-openshift-console.apps.<cluster-name>.<base domain>/ cache-control: no-cacheHTTP/1.1 200 OK referrer-policy: strict-origin-when-cross-origin set-cookie: csrf-token=39HoZgztDnzjJkq/JuLJMeoKNXlfiVv2YgZc09c3TBOBU4NI6kDXaJH1LdicNhN1UsQWzon4Dor9GWGfopaTEQ==; Path=/; Secure x-content-type-options: nosniff x-dns-prefetch-control: off x-frame-options: DENY x-xss-protection: 1; mode=block date: Tue, 17 Nov 2020 08:42:10 GMT content-type: text/html; charset=utf-8 set-cookie: 1e2670d92730b515ce3a1bb65da45062=9b714eb87e93cf34853e87a92d6894be; path=/; HttpOnly; Secure; SameSite=None cache-control: private次のコマンドを実行して出力を確認し、ポート 443 で各クラスターアプリケーションにアクセスできることを確認します。

$ curl https://console-openshift-console.apps.<cluster_name>.<base_domain> -I -L --insecure設定が正しい場合、コマンドの出力には次の応答が表示されます。

HTTP/1.1 200 OK referrer-policy: strict-origin-when-cross-origin set-cookie: csrf-token=UlYWOyQ62LWjw2h003xtYSKlh1a0Py2hhctw0WmV2YEdhJjFyQwWcGBsja261dGLgaYO0nxzVErhiXt6QepA7g==; Path=/; Secure; SameSite=Lax x-content-type-options: nosniff x-dns-prefetch-control: off x-frame-options: DENY x-xss-protection: 1; mode=block date: Wed, 04 Oct 2023 16:29:38 GMT content-type: text/html; charset=utf-8 set-cookie: 1e2670d92730b515ce3a1bb65da45062=1bf5e9573c9a2760c964ed1659cc1673; path=/; HttpOnly; Secure; SameSite=None cache-control: private

3.12. DHCP を使用したクラスターノードのホスト名の設定

Red Hat Enterprise Linux CoreOS (RHCOS) マシンでは、NetworkManager がホスト名を設定します。デフォルトでは、DHCP が NetworkManager にホスト名を提供します。これが推奨される方法です。NetworkManager は、次の場合に逆 DNS ルックアップを通じてホスト名を取得します。

- DHCP がホスト名を提供しない場合

- カーネル引数を使用してホスト名を設定する場合

- 別の方法でホスト名を設定する場合

逆 DNS ルックアップは、ノード上でネットワークが初期化された後に実行し、NetworkManager がホスト名を設定するのにかかる時間が長くなる可能性があります。NetworkManager がホスト名を設定する前に他のシステムサービスが起動することがあり、その場合は、それらのサービスが localhost などのデフォルトのホスト名を使用する可能性があります。

DHCP を使用して各クラスターノードにホスト名を提供することで、ホスト名の設定の遅延を回避できます。また、DHCP を介してホスト名を設定すると、DNS スプリットホライズンが実装されている環境での手動の DNS レコード名設定エラーを回避できます。

3.13. install-config.yaml ファイルの設定

3.13.1. install-config.yaml ファイルの設定

install-config.yaml ファイルには、追加の詳細情報が必要です。ほとんどの情報は、インストールプログラムと結果として作成されるクラスターに、完全に管理できる使用可能なハードウェアを十分に説明しています。

正しいイメージがリリースペイロードにあるため、インストールプログラムは、clusterOSImage RHCOS イメージを必要としなくなりました。

install-config.yamlを設定します。pullSecret、sshKeyなど、環境に合わせて適切な変数を変更します。apiVersion: v1 baseDomain: <domain> metadata: name: <cluster_name> networking: machineNetwork: - cidr: <public_cidr> networkType: OVNKubernetes compute: - name: worker replicas: 21 controlPlane: name: master replicas: 3 platform: baremetal: {} platform: baremetal: apiVIPs: - <api_ip> ingressVIPs: - <wildcard_ip> provisioningNetworkCIDR: <CIDR> bootstrapExternalStaticIP: <bootstrap_static_ip_address>2 bootstrapExternalStaticGateway: <bootstrap_static_gateway>3 bootstrapExternalStaticDNS: <bootstrap_static_dns>4 hosts: - name: openshift-master-0 role: master bmc: address: ipmi://<out_of_band_ip>5 username: <user> password: <password> bootMACAddress: <NIC1_mac_address> rootDeviceHints: deviceName: "<installation_disk_drive_path>"6 - name: <openshift_master_1> role: master bmc: address: ipmi://<out_of_band_ip> username: <user> password: <password> bootMACAddress: <NIC1_mac_address> rootDeviceHints: deviceName: "<installation_disk_drive_path>" - name: <openshift_master_2> role: master bmc: address: ipmi://<out_of_band_ip> username: <user> password: <password> bootMACAddress: <NIC1_mac_address> rootDeviceHints: deviceName: "<installation_disk_drive_path>" - name: <openshift_worker_0> role: worker bmc: address: ipmi://<out_of_band_ip> username: <user> password: <password> bootMACAddress: <NIC1_mac_address> - name: <openshift_worker_1> role: worker bmc: address: ipmi://<out_of_band_ip> username: <user> password: <password> bootMACAddress: <NIC1_mac_address> rootDeviceHints: deviceName: "<installation_disk_drive_path>" pullSecret: '<pull_secret>' sshKey: '<ssh_pub_key>'- 1

- OpenShift Container Platform クラスターの一部であるコンピュートノードの数に基づいて、コンピュートマシンをスケーリングします。

replicas値の有効なオプションは0で、2以上の整数です。3 ノードクラスターのみが含まれる 3 ノードクラスターをデプロイするには、レプリカ数を0に設定します。3 ノードクラスターは、テスト、開発、本番に使用できる、より小さく、よりリソース効率の良いクラスターです。コンピュートノードが 1 つだけのクラスターをインストールすることはできません。 - 2

- 静的 IP アドレスを使用してクラスターをデプロイする場合、ベアメタルネットワークに DHCP サーバーがない場合は、

bootstrapExternalStaticIP設定を設定して、ブートストラップ VM の静的 IP アドレスを指定する必要があります。 - 3

- 静的 IP アドレスを使用してクラスターをデプロイする場合、ベアメタルネットワークに DHCP サーバーがない場合は、

bootstrapExternalStaticGateway設定を設定して、ブートストラップ仮想マシンのゲートウェイ IP アドレスを指定する必要があります。 - 4

- 静的 IP アドレスを使用してクラスターをデプロイする場合、ベアメタルネットワークに DHCP サーバーがない場合は、

bootstrapExternalStaticDNS設定を設定して、ブートストラップ仮想マシンの DNS アドレスを指定する必要があります。 - 5

- その他のオプションについては、BMC アドレス指定のセクションを参照してください。

- 6

- インストールディスクドライブへのパスを設定するには、ディスクのカーネル名を入力します。たとえば、

/dev/sdaです。重要ディスクの検出順序は保証されていないため、複数のディスクを持つマシンでは、起動オプションによってディスクのカーネル名が変わる可能性があります。たとえば、

/dev/sdaは/dev/sdbになり、その逆も同様です。この問題を回避するには、ディスクの World Wide Name (WWN) や/dev/disk/by-path/などの永続的なディスク属性を使用する必要があります。ストレージの場所への/dev/disk/by-path/<device_path>リンクを使用することを推奨します。ディスク WWN を使用するには、deviceNameパラメーターをwwnWithExtensionパラメーターに置き換えます。使用するパラメーターに応じて、次のいずれかの値を入力します。-

ディスク名。たとえば、

/dev/sda、または/dev/disk/by-path/です。 -

ディスクの WWN。たとえば、

"0x64cd98f04fde100024684cf3034da5c2"です。ディスク WWN 値が 16 進数値ではなく文字列値として使用されるように、ディスク WWN 値を引用符で囲んで入力してください。

これらの

rootDeviceHintsパラメーター要件を満たさない場合、次のエラーが発生する可能性があります。ironic-inspector inspection failed: No disks satisfied root device hints -

ディスク名。たとえば、

注記OpenShift Container Platform 4.12 より前では、クラスターインストールプログラムが、

apiVIPおよびingressVIP設定の IPv4 アドレスまたは IPv6 アドレスのみを受け入れていました。OpenShift Container Platform 4.12 以降では、これらの設定は非推奨です。代わりに、apiVIPsおよびingressVIPs設定でリスト形式を使用して、IPv4 アドレス、IPv6 アドレス、または両方の IP アドレス形式を指定してください。クラスター設定を保存するディレクトリーを作成します。

$ mkdir ~/clusterconfigsinstall-config.yamlファイルを新しいディレクトリーにコピーします。$ cp install-config.yaml ~/clusterconfigsOpenShift Container Platform クラスターをインストールする前に、すべてのベアメタルノードの電源がオフになっていることを確認します。

$ ipmitool -I lanplus -U <user> -P <password> -H <management-server-ip> power off以前に試行したデプロイメントにより古いブートストラップリソースが残っている場合は、これを削除します。

for i in $(sudo virsh list | tail -n +3 | grep bootstrap | awk {'print $2'}); do sudo virsh destroy $i; sudo virsh undefine $i; sudo virsh vol-delete $i --pool $i; sudo virsh vol-delete $i.ign --pool $i; sudo virsh pool-destroy $i; sudo virsh pool-undefine $i; done

3.13.2. 追加の install-config パラメーター

install-config.yaml ファイルに必要なパラメーター hosts パラメーターおよび bmc パラメーターは、以下の表を参照してください。

| パラメーター | デフォルト | 説明 |

|---|---|---|

|

|

クラスターのドメイン名。たとえば、 | |

|

|

|

ノードのブートモード。オプションは、 |

|

|

ブートストラップノードの静的ネットワーク DNS。ベアメタルネットワークに Dynamic Host Configuration Protocol (DHCP) サーバーがない場合に、静的 IP アドレスを使用してクラスターをデプロイする場合は、この値を設定する必要があります。この値を設定しないと、インストールプログラムが | |

|

| ブートストラップ VM の静的 IP アドレス。ベアメタルネットワークに DHCP サーバーがない場合に、静的 IP アドレスを使用してクラスターをデプロイする場合は、この値を設定する必要があります。 | |

|

| ブートストラップ VM のゲートウェイの静的 IP アドレス。ベアメタルネットワークに DHCP サーバーがない場合に、静的 IP アドレスを使用してクラスターをデプロイする場合は、この値を設定する必要があります。 | |

|

|

| |

|

|

| |

|

OpenShift Container Platform クラスターに指定される名前。たとえば、 | |

|

外部ネットワークの公開 CIDR (Classless Inter-Domain Routing)。たとえば、 | |

| OpenShift Container Platform クラスターでは、ノードがゼロの場合でも、コンピュートノードに名前を付ける必要があります。 | |

| replicas は、OpenShift Container Platform クラスターのコンピュートノードの数を設定します。 | |

| OpenShift Container Platform クラスターでは、コントロールプレーンノードに名前が必要です。 | |

| replicas は、OpenShift Container Platform クラスターの一部として含まれるコントロールプレーンノードの数を設定します。 | |

|

|

ベアメタルネットワークに接続されたノード上のネットワークインターフェイス名。OpenShift Container Platform 4.9 以降のリリースのために、NIC の名前を識別するために | |

|

| プラットフォーム設定なしでマシンプールに使用されるデフォルト設定。 | |

|

| (オプション) Kubernetes API 通信の仮想 IP アドレス。

この設定は、 注記

OpenShift Container Platform 4.12 より前では、クラスターのインストールプログラムは | |

|

|

|

|

|

| (オプション) Ingress トラフィックの仮想 IP アドレス。

この設定は、 注記

OpenShift Container Platform 4.12 より前では、クラスターのインストールプログラムは |

| パラメーター | デフォルト | 説明 |

|---|---|---|

|

|

| プロビジョニングネットワークでノードの IP 範囲を定義します。 |

|

|

| プロビジョニングに使用するネットワークの CIDR。このオプションは、プロビジョニングネットワークでデフォルトのアドレス範囲を使用しない場合に必要です。 |

|

|

|

プロビジョニングサービスが実行されるクラスター内の IP アドレス。デフォルトは、プロビジョニングサブネットの 3 番目の IP アドレスに設定されます。たとえば、 |

|

|

|

インストーラーがコントロールプレーン (マスター) ノードをデプロイしている間にプロビジョニングサービスが実行されるブートストラップ仮想マシンの IP アドレス。デフォルトは、プロビジョニングサブネットの 2 番目の IP アドレスに設定されます。たとえば、 |

|

|

| ベアメタルネットワークに接続されたハイパーバイザーのベアメタルブリッジの名前。 |

|

|

|

プロビジョニングネットワークに接続されている |

|

|

クラスターのホストアーキテクチャーを定義します。有効な値は | |

|

| プラットフォーム設定なしでマシンプールに使用されるデフォルト設定。 | |

|

|

ブートストラップノードのデフォルトのオペレーティングシステムイメージを上書きするための URL。URL にはイメージの SHA-256 ハッシュが含まれている必要があります。たとえば、 | |

|

|

| |

|

| このパラメーターを、環境内で使用する適切な HTTP プロキシーに設定します。 | |

|

| このパラメーターを、環境内で使用する適切な HTTPS プロキシーに設定します。 | |

|

| このパラメーターを、環境内のプロキシーの使用に対する例外のリストに設定します。 |

3.13.2.1. ホスト

hosts パラメーターは、クラスターのビルドに使用される個別のベアメタルアセットのリストです。

| 名前 | デフォルト | 説明 |

|---|---|---|

|

|

詳細情報に関連付ける | |

|

|

ベアメタルノードのロール。 | |

|

| ベースボード管理コントローラーの接続詳細。詳細は、BMC アドレス指定のセクションを参照してください。 | |

|

|

ホストがプロビジョニングネットワークに使用する NIC の MAC アドレス。Ironic は、 注記 プロビジョニングネットワークを無効にした場合は、ホストから有効な MAC アドレスを提供する必要があります。 | |

|

| このオプションのパラメーターを設定して、ホストのネットワークインターフェイスを設定します。詳細は、「(オプション) ホストネットワークインターフェイスの設定」を参照してください。 |

3.13.3. BMC アドレス指定

ほとんどのベンダーは、Intelligent Platform Management Interface(IPMI) でベースボード管理コントローラー (BMC) アドレスに対応しています。IPMI は通信を暗号化しません。これは、セキュリティーが保護された管理ネットワークまたは専用の管理ネットワークを介したデータセンター内での使用に適しています。ベンダーを確認して、Redfish ネットワークブートをサポートしているかどうかを確認します。Redfish は、コンバージド、ハイブリッド IT および Software Defined Data Center (SDDC) 向けのシンプルでセキュアな管理を行います。Redfish は人による判読が可能、かつ機械対応が可能であり、インターネットや Web サービスの標準を活用して、最新のツールチェーンに情報を直接公開します。ハードウェアが Redfish ネットワークブートに対応していない場合には、IPMI を使用します。

ノードが Registering 状態にある間、インストール中に BMC アドレスを変更できます。ノードの Registering 状態が終了した後に BMC アドレスを変更する必要がある場合は、ノードを Ironic から切断し、BareMetalHost リソースを編集して、ノードを Ironic に再接続する必要があります。詳細は、BareMetalHost リソースの編集 セクションを参照してください。

3.13.3.1. IPMI

IPMI を使用するホストは ipmi://<out-of-band-ip>:<port> アドレス形式を使用します。これは、指定がない場合はポート 623 にデフォルトで設定されます。以下の例は、install-config.yaml ファイル内の IPMI 設定を示しています。

platform:

baremetal:

hosts:

- name: openshift-master-0

role: master

bmc:

address: ipmi://<out-of-band-ip>

username: <user>

password: <password>

BMC アドレス指定に IPMI を使用して PXE ブートする場合は、provisioning ネットワークが必要です。provisioning ネットワークなしでは、PXE ブートホストを行うことはできません。provisioning ネットワークなしでデプロイする場合、redfish-virtualmedia や idrac-virtualmedia などの仮想メディア BMC アドレス指定オプションを使用する必要があります。詳細は、「HPE iLO の BMC アドレス指定」セクションの「HPE iLO の Redfish 仮想メディア」、または「Dell iDRAC の BMC アドレス指定」セクションの「Dell iDRAC の Redfish 仮想メディア」を参照してください。

3.13.3.2. Redfish ネットワークブート

Redfish を有効にするには、redfish:// または redfish+http:// を使用して TLS を無効にします。インストーラーには、ホスト名または IP アドレスとシステム ID へのパスの両方が必要です。以下の例は、install-config.yaml ファイル内の Redfish 設定を示しています。

platform:

baremetal:

hosts:

- name: openshift-master-0

role: master

bmc:

address: redfish://<out-of-band-ip>/redfish/v1/Systems/1

username: <user>

password: <password>

アウトオブバンド管理のアドレスには認証局証明書を用意することを推奨します。ただし、自己署名証明書を使用する場合は、bmc 設定に disableCertificateVerification: True を含める必要があります。以下の例は、install-config.yaml ファイル内の disableCertificateVerification: True 設定パラメーターを使用する Redfish 設定を示しています。

platform:

baremetal:

hosts:

- name: openshift-master-0

role: master

bmc:

address: redfish://<out-of-band-ip>/redfish/v1/Systems/1

username: <user>

password: <password>

disableCertificateVerification: True3.13.4. Redfish API のサポートの確認

Redfish API を使用してインストールする場合、ベアメタル上で installer-provisioned infrastructure を使用する際に、インストールプログラムはベースボード管理コントローラー (BMC) 上の複数の Redfish エンドポイントを呼び出します。Redfish を使用する場合は、インストール前に BMC がすべての Redfish API をサポートしていることを確認してください。

手順

Redfish API のリスト

次のコマンドを実行して、

power onのサポートを確認します。$ curl -u $USER:$PASS -X POST -H'Content-Type: application/json' -H'Accept: application/json' -d '{"ResetType": "On"}' https://$SERVER/redfish/v1/Systems/$SystemID/Actions/ComputerSystem.Reset次のコマンドを実行して、

power offのサポートを確認します。$ curl -u $USER:$PASS -X POST -H'Content-Type: application/json' -H'Accept: application/json' -d '{"ResetType": "ForceOff"}' https://$SERVER/redfish/v1/Systems/$SystemID/Actions/ComputerSystem.Reset次のコマンドを実行して、

pxeを使用する一時的なブート実装を確認します。$ curl -u $USER:$PASS -X PATCH -H "Content-Type: application/json" -H "If-Match: <ETAG>" https://$Server/redfish/v1/Systems/$SystemID/ -d '{"Boot": {"BootSourceOverrideTarget": "pxe", "BootSourceOverrideEnabled": "Once"}}次のコマンドを実行して、

LegacyまたはUEFIを使用するファームウェアブートモードの設定ステータスを確認します。$ curl -u $USER:$PASS -X PATCH -H "Content-Type: application/json" -H "If-Match: <ETAG>" https://$Server/redfish/v1/Systems/$SystemID/ -d '{"Boot": {"BootSourceOverrideMode":"UEFI"}}

Redfish 仮想メディア API のリスト

次のコマンドを実行して、

cdまたはdvdを使用する一時ブートデバイスを設定できるか確認します。$ curl -u $USER:$PASS -X PATCH -H "Content-Type: application/json" -H "If-Match: <ETAG>" https://$Server/redfish/v1/Systems/$SystemID/ -d '{"Boot": {"BootSourceOverrideTarget": "cd", "BootSourceOverrideEnabled": "Once"}}'仮想メディアは、ハードウェアに応じて

POSTまたはPATCHを使用する場合があります。次のいずれかのコマンドを実行して、仮想メディアをマウントできるかどうかを確認します。$ curl -u $USER:$PASS -X POST -H "Content-Type: application/json" https://$Server/redfish/v1/Managers/$ManagerID/VirtualMedia/$VmediaId -d '{"Image": "https://example.com/test.iso", "TransferProtocolType": "HTTPS", "UserName": "", "Password":""}'$ curl -u $USER:$PASS -X PATCH -H "Content-Type: application/json" -H "If-Match: <ETAG>" https://$Server/redfish/v1/Managers/$ManagerID/VirtualMedia/$VmediaId -d '{"Image": "https://example.com/test.iso", "TransferProtocolType": "HTTPS", "UserName": "", "Password":""}'

Redfish API の PowerOn および PowerOff コマンドは、Redfish 仮想メディア API と同じです。一部のハードウェアでは、VirtualMedia リソースが Managers/$ManagerID ではなく Systems/$SystemID にのみ存在する場合があります。VirtualMedia リソースの場合、UserName と Password のフィールドはオプションです。

TransferProtocolTypes でサポートされているパラメータータイプは、HTTPS と HTTP のみです。

3.13.5. Dell iDRAC の BMC アドレス指定

各 bmc エントリーの address 設定は、URL スキーム内のコントローラーのタイプとネットワーク上の場所を含む、OpenShift Container Platform クラスターノードに接続するための URL です。各 bmc エントリーの username 設定では、Administrator 権限を持つユーザーを指定する必要があります。

platform:

baremetal:

hosts:

- name: <hostname>

role: <master | worker>

bmc:

address: <address>

username: <user>

password: <password>Dell ハードウェアの場合、Red Hat は統合 Dell Remote Access Controller (iDRAC) 仮想メディア、Redfish ネットワークブート、および IPMI をサポートします。

3.13.5.1. Dell iDRAC の BMC アドレス形式

| プロトコル | アドレスのフォーマット |

|---|---|

| iDRAC 仮想メディア |

|

| Redfish ネットワークブート |

|

| IPMI |

|

idrac-virtualmedia を Redfish 仮想メディアのプロトコルとして使用します。redfish-virtualmedia は Dell ハードウェアでは機能しません。Dell の idrac-virtualmedia は、Dell の OEM 拡張機能が含まれる Redfish 標準を使用します。

詳細は、以下のセクションを参照してください。

3.13.5.2. Dell iDRAC の Redfish 仮想メディア

Dell サーバーの Redfish 仮想メディアについては、address 設定で idrac-virtualmedia:// を使用します。redfish-virtualmedia:// を使用しても機能しません。

idrac-virtualmedia:// を Redfish 仮想メディアのプロトコルとして使用します。redfish-virtualmedia:// の使用は、idrac-virtualmedia:// プロトコルが idrac ハードウェアタイプおよび Ironic の Redfish プロトコルに対応しているため、Dell ハードウェアでは機能しません。Dell の idrac-virtualmedia:// プロトコルは、Dell の OEM 拡張機能が含まれる Redfish 標準を使用します。Ironic は、WSMAN プロトコルのある idrac タイプもサポートします。したがって、Dell ハードウェア上の仮想メディアで Redfish を使用する際に予期しない動作を回避するために、idrac-virtualmedia:// を指定する必要があります。

以下の例は、install-config.yaml ファイル内で iDRAC 仮想メディアを使用する方法を示しています。

platform:

baremetal:

hosts:

- name: openshift-master-0

role: master

bmc:

address: idrac-virtualmedia://<out_of_band_ip>/redfish/v1/Systems/System.Embedded.1

username: <user>

password: <password>

アウトバウンド管理のアドレスに認証局の証明書を使用することが推奨されますが、自己署名証明書を使用する場合には、bmc 設定に disableCertificateVerification: True を含める必要があります。

OpenShift Container Platform クラスターノードについて、iDRAC コンソールで AutoAttach が有効にされていることを確認します。メニューパスは Configuration → Virtual Media → Attach Mode → AutoAttach です。

次の例は、install-config.yaml ファイル内の disableCertificateVerification: True 設定パラメーターを使用した Redfish 設定を示しています。

platform:

baremetal:

hosts:

- name: openshift-master-0

role: master

bmc:

address: idrac-virtualmedia://<out_of_band_ip>/redfish/v1/Systems/System.Embedded.1

username: <user>

password: <password>

disableCertificateVerification: True3.13.5.3. iDRAC の Redfish ネットワークブート

Redfish を有効にするには、redfish:// または redfish+http:// を使用してトランスポート層セキュリティー (TLS) を無効にします。インストールプログラムにより、ホスト名または IP アドレスとシステム ID へのパスが求められます。以下の例は、install-config.yaml ファイル内の Redfish 設定を示しています。

platform:

baremetal:

hosts:

- name: openshift-master-0

role: master

bmc:

address: redfish://<out_of_band_ip>/redfish/v1/Systems/System.Embedded.1

username: <user>

password: <password>

アウトオブバンド管理のアドレスには認証局証明書を用意することを推奨します。ただし、自己署名証明書を使用する場合は、bmc 設定に disableCertificateVerification: True を含める必要があります。次の例は、install-config.yaml ファイル内の disableCertificateVerification: True 設定パラメーターを使用した Redfish 設定を示しています。

platform:

baremetal:

hosts:

- name: openshift-master-0

role: master

bmc:

address: redfish://<out_of_band_ip>/redfish/v1/Systems/System.Embedded.1

username: <user>

password: <password>

disableCertificateVerification: True

ファームウェアバージョン 04.40.00.00 を使用する Dell iDRAC 9 と、ベアメタルデプロイメントで installer-provisioned installation 用の 5.xx シリーズを含むすべてのリリースには既知の問題があります。Virtual Console プラグインは、HTML5 の拡張バージョンである eHTML5 にデフォルト設定されているため、InsertVirtualMedia ワークフローで問題が発生します。この問題を回避するには、HTML5 を使用するようにプラグインを設定します。メニューパスは以下の通りです。Configuration → Virtual console → Plug-in Type → HTML5

OpenShift Container Platform クラスターノードについて、iDRAC コンソールで AutoAttach が有効にされていることを確認します。メニューパスは以下のようになります。Configuration → Virtual Media → Attach Mode → AutoAttach

3.13.6. HPE iLO の BMC アドレス指定

それぞれの bmc エントリーの address フィールドは、URL スキーム内のコントローラーのタイプやネットワーク上のその場所を含む、OpenShift Container Platform クラスターノードに接続する URL です。

platform:

baremetal:

hosts:

- name: <hostname>

role: <master | worker>

bmc:

address: <address>

username: <user>

password: <password>- 1

address設定はプロトコルを指定します。

HPE integrated Lights Out (iLO) の場合、Red Hat は Redfish 仮想メディア、Redfish ネットワークブート、および IPMI をサポートします。

| プロトコル | アドレスのフォーマット |

|---|---|

| Redfish 仮想メディア |

|

| Redfish ネットワークブート |

|

| IPMI |

|

詳細は、以下のセクションを参照してください。

3.13.6.1. HPE iLO の Redfish 仮想メディア

HPE サーバーの Redfish 仮想メディアを有効にするには、address 設定で redfish-virtualmedia:// を使用します。以下の例は、install-config.yaml ファイル内で Redfish 仮想メディアを使用する方法を示しています。

platform:

baremetal:

hosts:

- name: openshift-master-0

role: master

bmc:

address: redfish-virtualmedia://<out-of-band-ip>/redfish/v1/Systems/1

username: <user>

password: <password>

アウトオブバンド管理のアドレスには認証局証明書を用意することを推奨します。ただし、自己署名証明書を使用する場合は、bmc 設定に disableCertificateVerification: True を含める必要があります。以下の例は、install-config.yaml ファイル内の disableCertificateVerification: True 設定パラメーターを使用する Redfish 設定を示しています。

platform:

baremetal:

hosts:

- name: openshift-master-0

role: master

bmc:

address: redfish-virtualmedia://<out-of-band-ip>/redfish/v1/Systems/1

username: <user>

password: <password>

disableCertificateVerification: TrueIronic は、仮想メディアで iLO4 をサポートしないので、Redfish 仮想メディアは、iLO4 を実行する第 9 世代のシステムではサポートされません。

3.13.6.2. HPE iLO の Redfish ネットワークブート

Redfish を有効にするには、redfish:// または redfish+http:// を使用して TLS を無効にします。インストーラーには、ホスト名または IP アドレスとシステム ID へのパスの両方が必要です。以下の例は、install-config.yaml ファイル内の Redfish 設定を示しています。

platform:

baremetal:

hosts:

- name: openshift-master-0

role: master

bmc:

address: redfish://<out-of-band-ip>/redfish/v1/Systems/1

username: <user>

password: <password>

アウトオブバンド管理のアドレスには認証局証明書を用意することを推奨します。ただし、自己署名証明書を使用する場合は、bmc 設定に disableCertificateVerification: True を含める必要があります。以下の例は、install-config.yaml ファイル内の disableCertificateVerification: True 設定パラメーターを使用する Redfish 設定を示しています。

platform:

baremetal:

hosts:

- name: openshift-master-0

role: master

bmc:

address: redfish://<out-of-band-ip>/redfish/v1/Systems/1

username: <user>

password: <password>

disableCertificateVerification: True3.13.7. Fujitsu iRMC の BMC アドレス指定

それぞれの bmc エントリーの address フィールドは、URL スキーム内のコントローラーのタイプやネットワーク上のその場所を含む、OpenShift Container Platform クラスターノードに接続する URL です。

platform:

baremetal:

hosts:

- name: <hostname>

role: <master | worker>

bmc:

address: <address>

username: <user>

password: <password>- 1

address設定はプロトコルを指定します。

Fujitsu ハードウェアの場合、Red Hat は、統合 Remote Management Controller (iRMC) および IPMI をサポートします。

| プロトコル | アドレスのフォーマット |

|---|---|

| iRMC |

|

| IPMI |

|

iRMC