仮想化

OpenShift Virtualization のインストール、使用方法、およびリリースノート

概要

第1章 OpenShift Virtualization について

OpenShift Virtualization の機能およびサポート範囲について確認します。

1.1. OpenShift Virtualization の機能

OpenShift virtualization は OpenShift Container Platform のアドオンであり、仮想マシンのワークロードを実行し、このワークロードをコンテナーのワークロードと共に管理することを可能にします。

OpenShift Virtualization は、Kubernetes カスタムリソースにより新規オブジェクトを OpenShift Container Platform クラスターに追加し、仮想化タスクを有効にします。これらのタスクには、以下が含まれます。

- Linux および Windows 仮想マシンの作成と管理

- 各種コンソールおよび CLI ツールの使用による仮想マシンへの接続

- 既存の仮想マシンのインポートおよびクローン作成

- ネットワークインターフェイスコントローラーおよび仮想マシンに割り当てられたストレージディスクの管理

- 仮想マシンのノード間でのライブマイグレーション

機能強化された Web コンソールは、これらの仮想化されたリソースを OpenShift Container Platform クラスターコンテナーおよびインフラストラクチャーと共に管理するためのグラフィカルポータルを提供します。

OpenShift Virtualization は、Red Hat OpenShift Data Foundation の機能とうまく連携するように設計およびテストされています。

OpenShift Data Foundation を使用して OpenShift Virtualization をデプロイする場合は、Windows 仮想マシンディスク用の専用ストレージクラスを作成する必要があります。詳細は 、Windows VM の ODF PersistentVolumes の最適化 を参照してください。

OpenShift Virtualization は、OVN-Kubernetes、OpenShiftSDN、または 認定 OpenShift CNI プラグイン に一記載されている他の認定デフォルトの Container Network Interface (CNI) ネットワークプロバイダーの 1 つと使用できます。

Compliance Operator をインストールし、ocp4-moderate および ocp4-moderate-node プロファイル を使用してスキャンを実行することにより、OpenShift Virtualization クラスターのコンプライアンスの問題を確認できます。Compliance Operator は、NIST 認定ツール である OpenSCAP を使用して、セキュリティーポリシーをスキャンし、適用します。

OpenShift Virtualization と Compliance Operator の統合は、テクノロジープレビュー機能のみです。テクノロジープレビュー機能は、Red Hat 製品のサービスレベルアグリーメント (SLA) の対象外であり、機能的に完全ではないことがあります。Red Hat は、実稼働環境でこれらを使用することを推奨していません。テクノロジープレビュー機能は、最新の製品機能をいち早く提供して、開発段階で機能のテストを行いフィードバックを提供していただくことを目的としています。

Red Hat のテクノロジープレビュー機能のサポート範囲に関する詳細は、テクノロジープレビュー機能のサポート範囲 を参照してください。

1.1.1. OpenShift Virtualization サポートのクラスターバージョン

OpenShift Virtualization 4.11 は OpenShift Container Platform 4.11 クラスターで使用するためにサポートされます。Open Shift Virtualization の最新の z-stream リリースを使用するには、最初に Open Shift Container Platform の最新バージョンにアップグレードする必要があります。

第2章 OpenShift Virtualization アーキテクチャー

OpenShift Virtualization アーキテクチャーについて学習します。

2.1. OpenShift Virtualization アーキテクチャーの仕組み

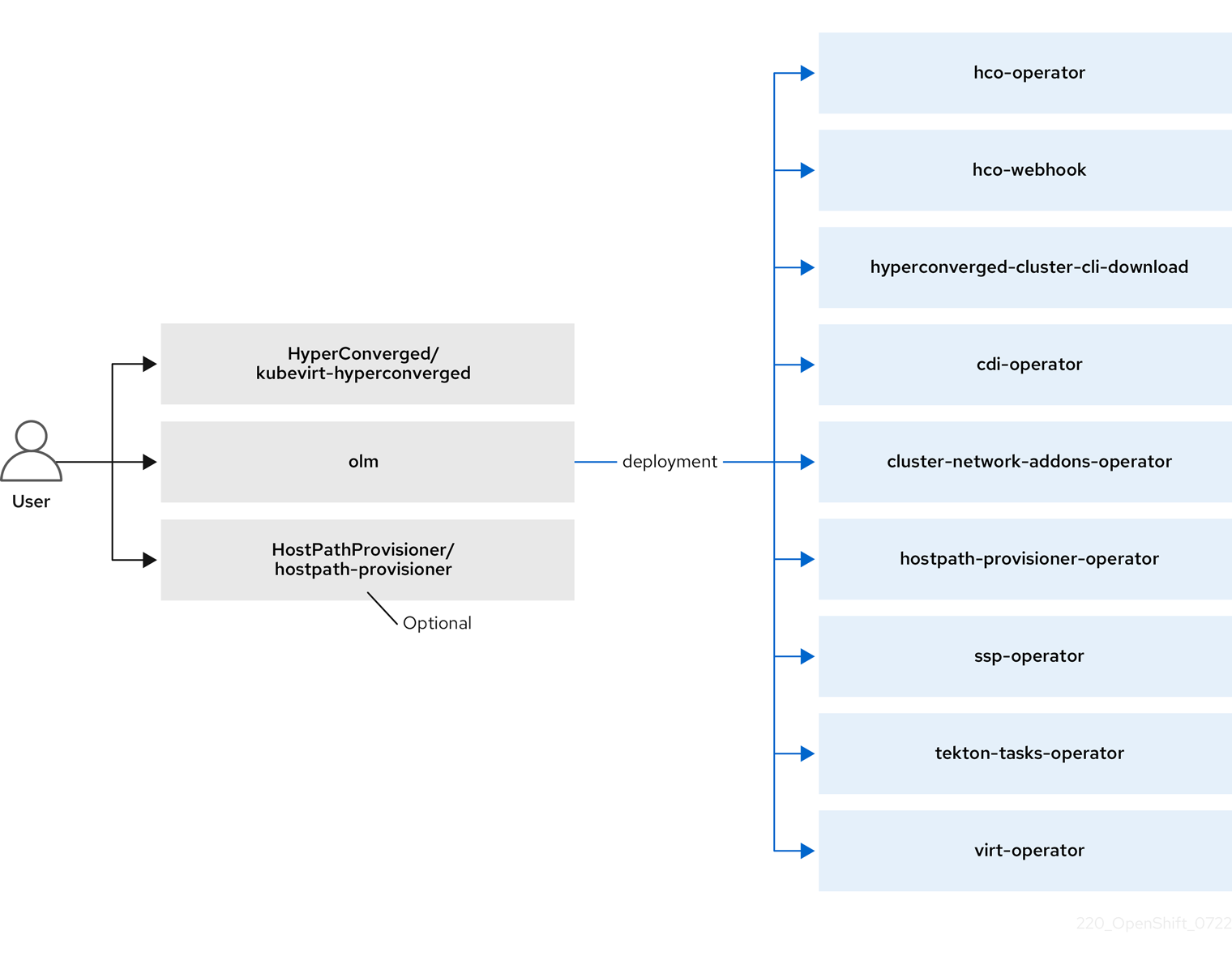

OpenShift Virtualization をインストールすると、Operator Lifecycle Manager (OLM) は、OpenShift Virtualization の各コンポーネントのオペレーター Pod をデプロイします。

-

コンピューティング:

virt-operator -

ストレージ:

cdi-operator -

ネットワーク:

cluster-network-addons-operator -

スケーリング:

ssp-operator -

テンプレート作成:

tekton-tasks-operator

OLM は、他のコンポーネントのデプロイ、設定、およびライフサイクルを担当する hyperconverged-cluster-operator Pod と、いくつかのヘルパー Pod (hco-webhook および hyperconverged-cluster-cli-download) もデプロイします。

すべての Operator Pod が正常にデプロイされたら、HyperConverged カスタム リソース (CR) を作成する必要があります。HyperConverged CR で設定された設定は、信頼できる唯一の情報源および OpenShift Virtualization のエントリーポイントとして機能し、CR の動作をガイドします。

HyperConverged CR は、調整ループ内の他のすべてのコンポーネントの Operator に対応する CR を作成します。その後、各 Operator は、デーモンセット、config map、および OpenShift Virtualization コントロールプレーン用の追加コンポーネントなどのリソースを作成します。たとえば、hco-operator が KubeVirt CR を作成すると、virt-operator はそれを調整し、virt-controller、virt-handler、virt-api などの追加リソースを作成します。

OLM は hostpath-provisioner-operator をデプロイしますが、hostpath provisioner (HPP) CR を作成するまで機能しません。

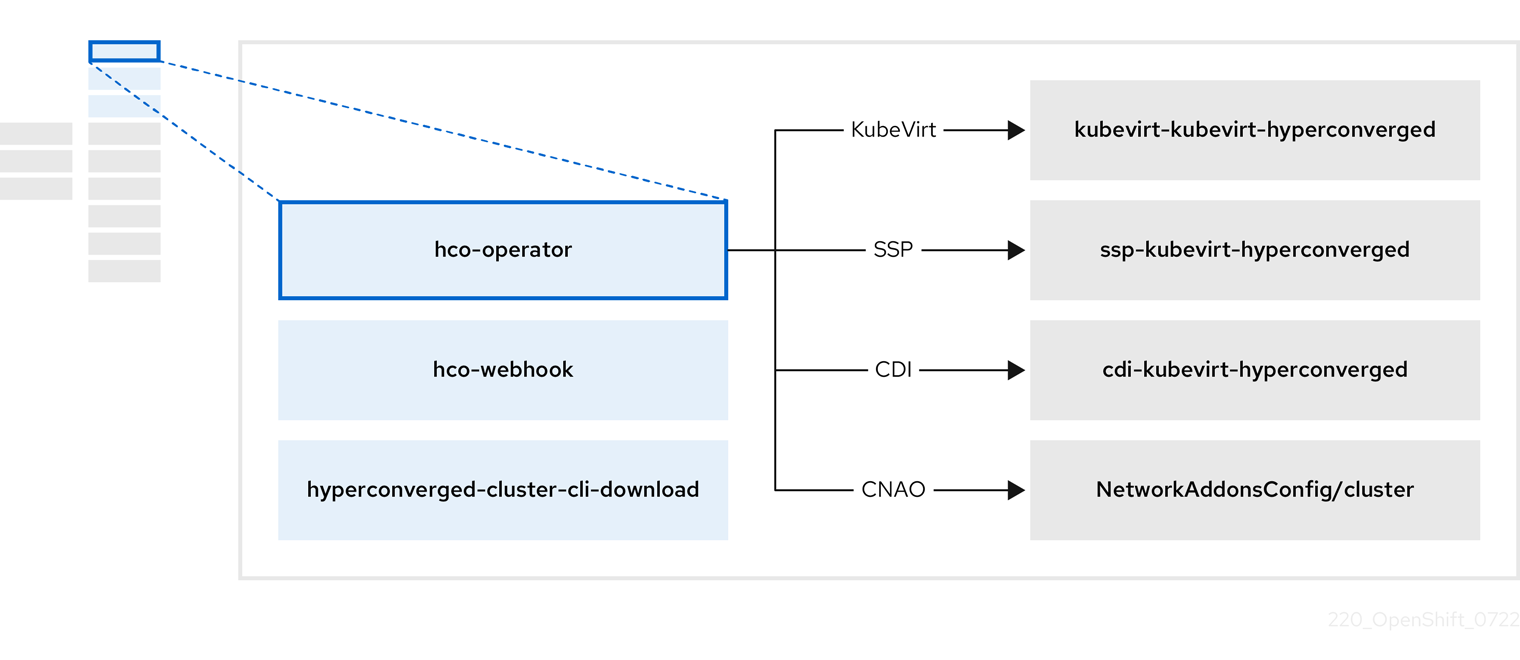

2.2. hco-operator について

hco- operator (HCO) は、OpenShift Virtualization をデプロイおよび管理するための単一のエントリーポイントと、独自のデフォルトを持ついくつかのヘルパー Operator を提供します。また、これらの Operator のカスタム リソース (CR) も作成します。

| コンポーネント | 説明 |

|---|---|

|

|

|

|

|

クラスターから直接ダウンロードできるように、 |

|

| OpenShift Virtualization に必要なすべての Operator、CR、およびオブジェクトが含まれています。 |

|

| SSP CR。これは、HCO によって自動的に作成されます。 |

|

| A CDI CR。これは、HCO によって自動的に作成されます。 |

|

|

|

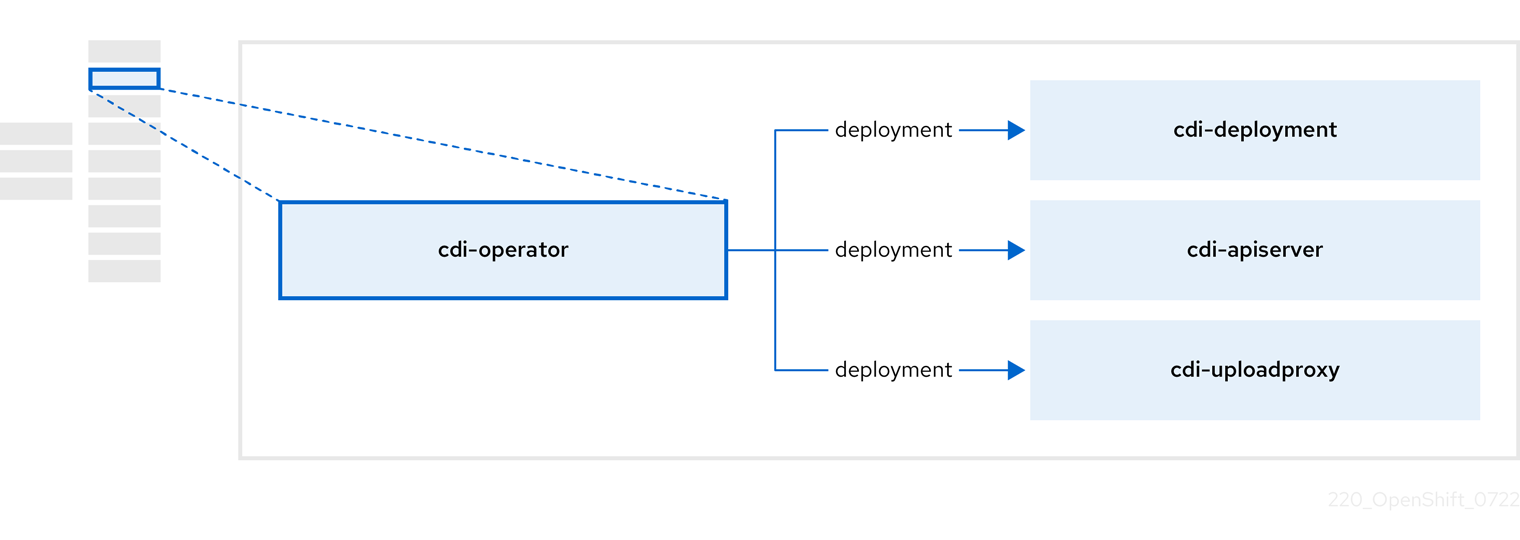

2.3. cdi-operator について

cdi-operator は、Containerized Data Importer (CDI) とその関連リソースを管理します。これは、データ ボリュームを使用して仮想マシン (VM) イメージを永続ボリューム要求 (PVC) にインポートします。

| コンポーネント | 説明 |

|---|---|

|

| 安全なアップロードトークンを発行して、VM ディスクを PVC にアップロードするための承認を管理します。 |

|

| 外部ディスクのアップロードトラフィックを適切なアップロードサーバー Pod に転送して、正しい PVC に書き込むことができるようにします。有効なアップロードトークンが必要です。 |

|

| データ ボリュームの作成時に仮想マシンイメージを PVC にインポートするヘルパー Pod。 |

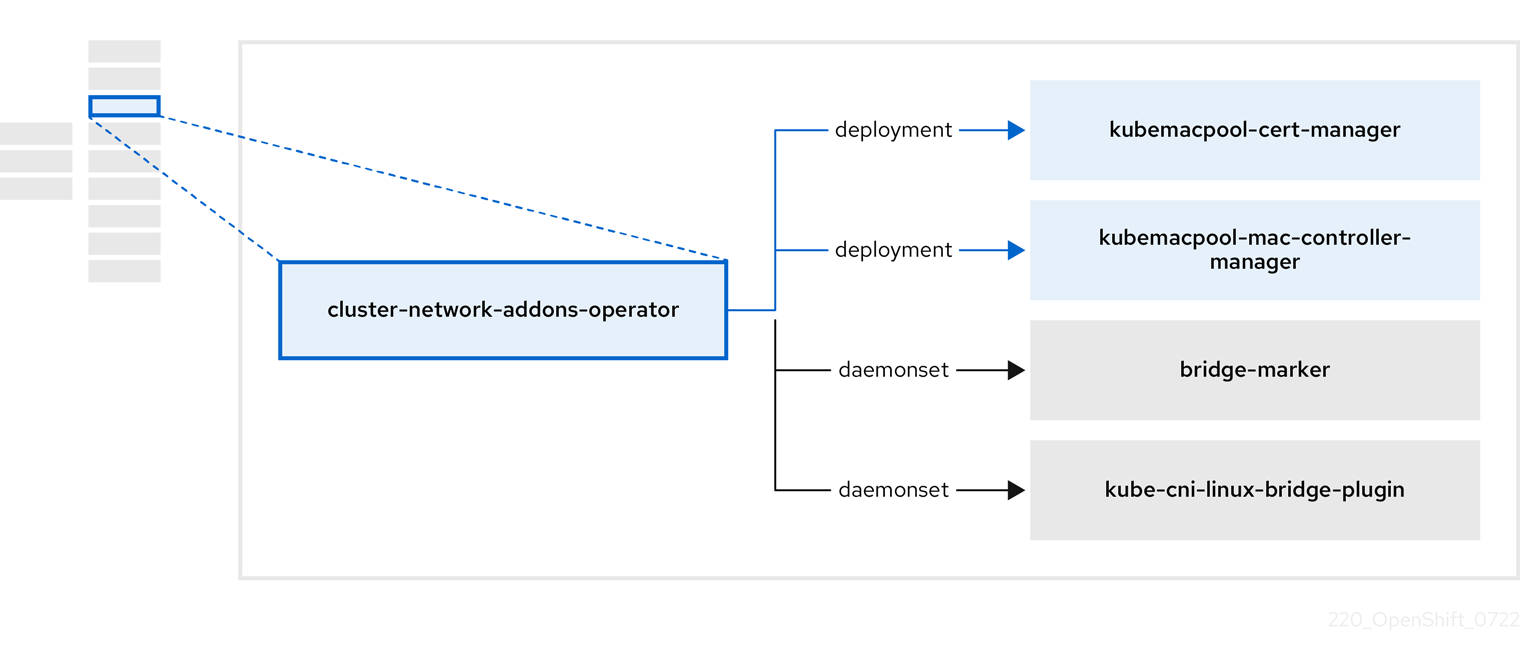

2.4. cluster-network-addons-operator について

cluster-network-addons-operator は、ネットワーク コンポーネントをクラスターにデプロイし、ネットワーク機能を拡張するための関連リソースを管理します。

| コンポーネント | 説明 |

|---|---|

|

| Kubemacpool の Webhook の TLS 証明書を管理します。 |

|

| 仮想マシン (VM) ネットワークインターフェイス カード (NIC) の MAC アドレスプールサービスを提供します。 |

|

| ノードで使用可能なネットワークブリッジをノードリソースとしてマークします。 |

|

| クラスターノードに CNI プラグインをインストールし、ネットワーク接続定義を介して Linux ブリッジに VM を接続できるようにします。 |

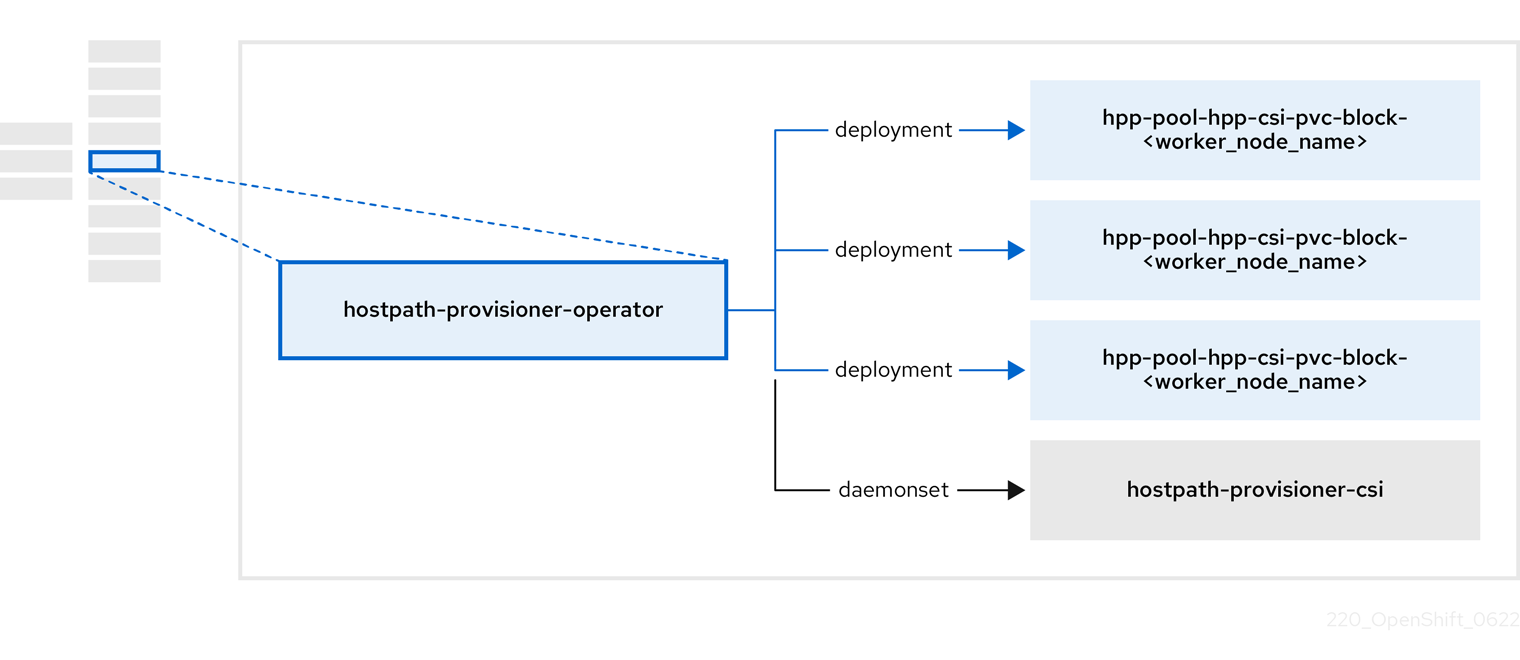

2.5. hostpath-provisioner-operator について

hostpath-provisioner-operator は、マルチノードホストパスプロビジョナー (HPP) および関連リソースをデプロイおよび管理します。

| コンポーネント | 説明 |

|---|---|

|

| ホストパスプロビジョナー (HPP) の実行が指定されている各ノードにワーカーを提供します。Pod は、指定されたバッキングストレージをノードにマウントします。 |

|

| HPP の Container Storage Interface (CSI) ドライバーインターフェイスを実装します。 |

|

| HPP のレガシードライバーインターフェイスを実装します。 |

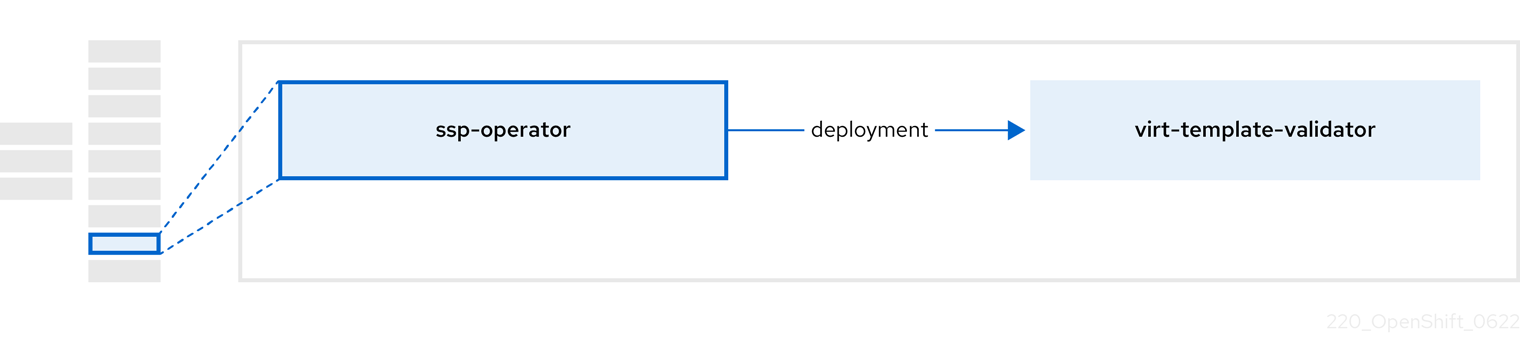

2.6. ssp-operator について

ssp-operator は、共通テンプレート、関連するデフォルトのブートソース、およびテンプレートバリデーターをデプロイします。

| コンポーネント | 説明 |

|---|---|

|

|

テンプレートから作成された仮想マシンの |

2.7. tekton-tasks-operator について

tekton-tasks-operator は、VM 用の OpenShift パイプラインの使用法を示すサンプルパイプラインをデプロイします。また、ユーザーがテンプレートから VM を作成し、テンプレートをコピーおよび変更し、データボリュームを作成できるようにする追加の OpenShift Pipeline タスクをデプロイします。

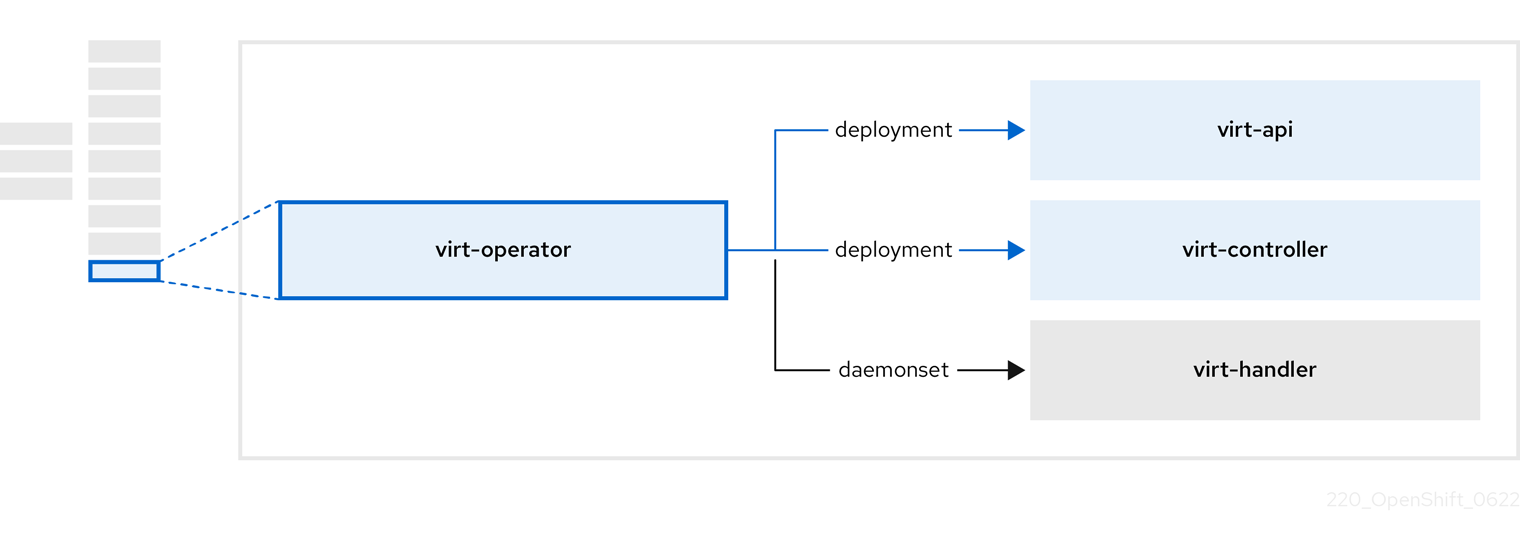

2.8. 仮想 Operator について

virt-operator は、現在の仮想マシン (VM) のワークロードを中断することなく、OpenShift Virtualization をデプロイ、アップグレード、および管理します。

| コンポーネント | 説明 |

|---|---|

|

| すべての仮想化関連フローのエントリーポイントとして機能する HTTP API サーバー。 |

|

|

新しい VM インスタンス オブジェクトの作成を監視し、対応する Pod を作成します。Pod がノードでスケジュールされると、 |

|

|

VM への変更を監視し、必要な操作を実行するように |

|

|

|

第3章 OpenShift Virtualization の開始

基本的な OpenShift Virtualization 環境をインストールして設定し、その特徴と機能を調べることができます。

クラスター設定手順には、cluster-admin 権限が必要です。

3.1. 作業を開始する前に

- OpenShift Virtualization 用に クラスターを準備します。

- クローン作成、スナップショット、およびライブマイグレーションの ストレージ要件 を確認します。

- OpenShift Virtualization Operator をインストールします。

-

virtctlツール をインストールします。

3.2. スタートガイド

仮想マシンを作成します。

- Web コンソールを使用して仮想マシンを クイック作成 します。

- Windows ブート ソース を作成してカスタマイズします。

- 仮想マシンに VirtIO ドライバーと QEMU ゲストエージェント をインストールします。

仮想マシンに接続します。

- 仮想マシンに接続する

- 仮想マシンの管理

- Web コンソールから 仮想マシンを停止、開始、一時停止、再起動します。

-

仮想マシンを管理し、ポートを公開し、コマンド ラインから

virtctlを使用して仮想マシンのシリアルコンソールに接続します。

3.3. 次のステップ

- 仮想マシンをセカンダリーネットワークに接続する

- OpenShift Virtualization 環境を監視する

- 仮想化の概要ページ で、リソース、詳細、ステータス、上位のコンシューマーを監視します。

- 仮想マシンダッシュボード で、仮想マシンに関する概要情報を表示します。

- 仮想マシンの ログ を表示します。

- デプロイメントの自動化

-

sysprepを使用して Windows 仮想マシンのデプロイメントを自動化 します。

-

第4章 OpenShift Virtualization リリースノート

4.1. 多様性を受け入れるオープンソースの強化

Red Hat では、コード、ドキュメント、Web プロパティーにおける配慮に欠ける用語の置き換えに取り組んでいます。まずは、マスター (master)、スレーブ (slave)、ブラックリスト (blacklist)、ホワイトリスト (whitelist) の 4 つの用語の置き換えから始めます。この取り組みは膨大な作業を要するため、今後の複数のリリースで段階的に用語の置き換えを実施して参ります。詳細は、Red Hat CTO である Chris Wright のメッセージ をご覧ください。

4.2. Red Hat OpenShift Virtualization について

Red Hat OpenShift Virtualization は、従来の仮想マシン (VM) をコンテナーと共に実行される OpenShift Container Platform に組み込み、それらをネイティブ Kubernetes オブジェクトとして管理することを可能にします。

OpenShift Virtualization は、

![]() アイコンで表されます。

アイコンで表されます。

OVN-Kubernetes または OpenShiftSDN のデフォルトの Container Network Interface (CNI) ネットワークプロバイダーのいずれかで OpenShift Virtualization を使用できます。

OpenShift Virtualization の機能 について参照してください。

OpenShift Virtualization のアーキテクチャーとデプロイメント の詳細を参照してください。

OpenShift Virtualization 用に クラスターを準備します。

4.2.1. OpenShift Virtualization サポートのクラスターバージョン

OpenShift Virtualization 4.11 は OpenShift Container Platform 4.11 クラスターで使用するためにサポートされます。Open Shift Virtualization の最新の z-stream リリースを使用するには、最初に Open Shift Container Platform の最新バージョンにアップグレードする必要があります。

4.2.2. サポート対象のゲストオペレーティングシステム

OpenShift Virtualization でサポートされているゲストオペレーティングシステムを確認するにはCertified Guest Operating Systems in Red Hat OpenStack Platform, Red Hat Virtualization and OpenShift Virtualization参照してください。

4.3. 新機能および変更された機能

- コンピュートノードがゼロの 3 ノードクラスター に OpenShift Virtualization をデプロイできるようになりました。

- デフォルトでは、仮想マシンは非特権ワークロードとしてセッションモードで実行されます。この機能は、escalation-of-privilege 攻撃を軽減することでクラスターのセキュリティーを向上させます。

- Red Hat Enterprise Linux (RHEL) 9 がゲストオペレーティングシステムとしてサポートされるようになりました。

- OpenShift Container Platform Web コンソールに Migration Toolkit for Virtualization (MTV) Operator をインストールするためのリンクが移動されました。現在は、Virtualization → Overview ページの Getting started resources カードの Related operators セクションにあります。

-

HyperConvergedカスタム リソース (CR) を編集することで、virtLauncher、virtHandler、virtController、virtAPI、およびvirtOperatorPod ログの 詳細レベル を設定して、特定のコンポーネントをデバッグできます。

4.3.1. クイックスタート

-

クイックスタートツアーは、複数の OpenShift Virtualization 機能で利用できます。ツアーを表示するには、OpenShift Virtualization コンソールのヘッダーのメニューバーにある Help アイコン ? をクリックし、Quick Starts を選択します。Filter フィールドに

virtualizationキーワードを入力して、利用可能なツアーをフィルタリングできます。

4.3.2. ストレージ

- 仮想マシンのスナップショット に関する情報を提供する新しいメトリックを使用できます。

- 非接続環境のログ数を減らしたり、リソースの使用量を減らしたりできます。そのためには、事前定義済みブートソースの自動インポートと更新を無効 にします。

4.3.3. Web コンソール

- Web コンソールを使用して、テンプレートおよび仮想マシンの 起動モード を BIOS、UEFI、または UEFI (セキュア) に設定できます。

- VirtualMachine details ページの Scheduling タブで、Web コンソールから descheduler を有効または無効にできるようになりました。

- サイドメニューの Virtualization → VirtualMachines に移動して、仮想マシンにアクセスできます。各仮想マシンには、仮想マシンの設定、アラート、スナップショット、ネットワークインターフェイス、ディスク、使用状況データ、およびハードウェアデバイスに関する情報を提供する、更新された Overview タブ が表示されるようになりました。

- Web コンソールの Create a Virtual Machine ウィザードは仮想マシンの作成に使用できる使用可能なテンプレートをリスト表示する カタログ ページに置き換えられました。使用可能なブートソースを備えたテンプレートを使用して仮想マシンをすばやく作成したり、テンプレートをカスタマイズして仮想マシンを作成したりできます。

- Windows 仮想マシンに vGPU が接続されている場合、Web コンソールを使用して、デフォルトのディスプレイと vGPU ディスプレイを切り替える ことができるようになりました。

- サイド メニューの Virtualization → Templates に移動して、仮想マシンテンプレートにアクセスできます。更新された VirtualMachine Templates ページでは、ワークロードプロファイル、ブートソース、CPU とメモリーの設定など、各テンプレートに関する有用な情報が提供されるようになりました。

- Create Template ウィザードは VirtualMachine Templates ページから削除されました。YAML ファイルの例を編集して、仮想マシンテンプレートを作成 します。

4.4. 非推奨および削除された機能

4.4.1. 非推奨の機能

非推奨の機能は現在のリリースに含まれており、サポートされています。ただし、これらは今後のリリースで削除されるため、新規デプロイメントでの使用は推奨されません。

- 今後のリリースでは、従来の HPP カスタムリソースと関連するストレージクラスのサポートは非推奨になります。OpenShift Virtualization 4.11 以降、HPP Operator は Kubernetes Container Storage Interface (CSI) ドライバーを使用してローカルストレージを設定します。Operator は、引き続き HPP カスタムリソースの既存の (レガシー) 形式および関連付けられたストレージクラスをサポートします。HPP Operator を使用する場合、移行ストラテジーの一部として CSI ドライバーのストレージクラスを作成する ことを計画してください。

4.4.2. 削除された機能

削除された機能は、現在のリリースではサポートされません。

OpenShift Virtualization 4.11 は、以下のオブジェクトを含む nmstate のサポートを削除します。

-

NodeNetworkState -

NodeNetworkConfigurationPolicy -

NodeNetworkConfigurationEnactment

既存の nmstate 設定を維持およびサポートするには、OpenShift Virtualization 4.11 に更新する前に Kubernetes NMState Operator をインストールします。これは、OpenShift Container Platform Web コンソールの OperatorHub から、または OpenShift CLI (

oc) を使用してインストールできます。-

Node Maintenance Operator (NMO) は OpenShift Virtualization に同梱されなくなりました。これは、OpenShift Container Platform Web コンソールの OperatorHub から NMO をインストール、または OpenShift CLI (

oc) を使用してインストールできます。OpenShift Virtualization 4.10.2 以降のリリースから OpenShift Virtualization 4.11 に更新する前に、以下のいずれかのタスクを実行する必要があります。

- すべてのノードをメンテナンスモードから移動します。

-

スタンドアロン NMO をインストールし、

nodemaintenances.nodemaintenance.kubevirt.ioカスタムリソース (CR) をnodemaintenances.nodemaintenance.medik8s.ioCR に置き換えます。

- 仮想マシンテンプレートをお気に入りとしてマークできなくなりました。

4.5. テクノロジープレビューの機能

現在、今回のリリースに含まれる機能にはテクノロジープレビューのものがあります。これらの実験的機能は、実稼働環境での使用を目的としていません。これらの機能に関しては、Red Hat カスタマーポータルの以下のサポート範囲を参照してください。

- Microsoft Windows 11 をゲスト OS として使用できるようになりました。ただし、OpenShift Virtualization 4.11 は、BitLocker リカバリーの重要な機能に必要な USB ディスクをサポートしていません。回復キーを保護するには、BitLocker recovery guide で説明されている他の方法を使用します。

- OpenShift Virtualization を AWS ベアメタルノードにデプロイできるようになりました。

- OpenShift Virtualization には、緊急の対応が必要な問題が発生したときに通知する 重要なアラート があります。各アラートには、問題に対する説明、アラートが発生した理由、問題の原因を診断するためのトラブルシューティングプロセス、およびアラートの解決手順が含まれるようになりました。

-

管理者は、

HyperConvergedCR を編集することにより、宣言的に、仮想グラフィックス処理ユニット (vGPU) などの仲介デバイスを作成および公開できるようになりました。仮想マシンの所有者は、これらのデバイスを仮想マシンに割り当てることができます。

-

単一の

NodeNetworkConfigurationPolicyマニフェストをクラスターに適用することにより、ブリッジに接続されている NIC の静的 IP 設定を転送できます。

- OpenShift Virtualization を IBM Cloud ベアメタルサーバーにインストールできるようになりました。他のクラウドプロバイダーが提供するベアメタルサーバーはサポートされません。

-

Compliance Operator をインストールし、

ocp4-moderateおよびocp4-moderate-nodeプロファイル を使用してスキャンを実行することにより、OpenShift Virtualization クラスターのコンプライアンスの問題を確認できます。

- OpenShift Virtualization には、クラスターのメンテナンスとトラブルシューティングに使用できる定義済みのチェックアップを実行するための 診断フレームワーク が含まれるようになりました。定義済みのチェックアップを実行して、セカンダリー ネットワーク上の仮想マシンの ネットワーク接続性とレイテンシーをチェック できます。

- 帯域幅の使用率、並列移行の最大数、タイムアウトなどの特定のパラメーターを使用してライブマイグレーションポリシーを作成し、仮想マシンと namespace のラベルを使用して、仮想マシンのグループにポリシーを適用できます。

4.6. バグ修正

- 以前は、大規模なクラスターでは OpenShift Virtualization MAC プールマネージャーの起動に時間がかかりすぎる可能性があり、OpenShift Virtualization が準備状態にならないことがありました。今回の更新により、プールの初期化と起動の待ち時間が短縮されました。その結果、仮想マシンを正常に定義できるようになりました。(BZ#2035344)

- シャットダウン中に Windows 仮想マシンがクラッシュまたはハングした場合、手動で強制シャットダウンリクエストを発行して仮想マシンを停止できるようになりました。(BZ#2040766)

- 仮想マシンウィザードの YAML の例が更新され、アップストリームの最新の変更が含まれるようになりました。(BZ#2055492)

- VM Network Interfaces タブの Add Network Interface ボタンが、非特権ユーザーに対して無効にならなくなりました。(BZ#2056420)

- 非特権ユーザーは、RBAC ルールエラーを取得することなく、仮想マシンにディスクを正常に追加できるようになりました。(BZ#2056421)

- Web コンソールは、カスタム namespace にデプロイされた仮想マシンテンプレートを正常に表示するようになりました。(BZ#2054650)

-

以前は、

spec.evictionStrategyフィールドが VMI のLiveMigrateに設定されている場合、Single Node OpenShift (SNO) クラスターの更新が失敗していました。ライブマイグレーションを成功させるには、クラスターに複数のコンピュートノードが必要です。今回の更新により、spec.evictionStrategyフィールドが SNO 環境の仮想マシンテンプレートから削除されました。その結果、クラスターの更新が成功するようになりました。(BZ#2073880)

4.7. 既知の問題

- シングルスタックの IPv6 クラスターで OpenShift Virtualization は実行できません。(BZ#2193267)

- コンピュートノードがさまざま含まれる、異種クラスターでは、HyperV Reenlightenment が有効になっている仮想マシンは、タイムスタンプカウンタースケーリング (TSC) をサポートしていないノード、TSC 頻度が非季節なノードでスケジュールできません。(BZ#2151169)

異なる SELinux コンテキストで 2 つの Pod を使用すると、

ocs-storagecluster-cephfsストレージクラスの VM が移行に失敗し、VM のステータスがPausedに変わります。これは、両方の Pod がReadWriteManyCephFS の共有ボリュームに同時にアクセスしようとするためです。(BZ#2092271)-

回避策として、

ocs-storagecluster-ceph-rbdストレージクラスを使用して、Red Hat Ceph Storage を使用するクラスターで VM をライブマイグレーションします。

-

回避策として、

OpenShift Virtualization を更新せずに OpenShift Container Platform をバージョン 4.11 に更新すると、VM スナップショットの復元に失敗します。これは、スナップショットオブジェクトに使用される API バージョン間の不一致が原因です。(BZ#2159442)

- 回避策として、OpenShift Virtualization を OpenShift Container Platform と同じマイナーバージョンに更新します。バージョンが同期されていることを確認するには、推奨される Automatic 承認ストラテジーを使用してください。

- OpenShift Virtualization をアンインストールしても、OpenShift Virtualization によって作成されたノードラベルは削除されません。ラベルは手動で削除する必要があります。(CNV-22036)

OVN-Kubernetes クラスターネットワークプロバイダーは、大量の

NodePortサービスを作成すると、RAM と CPU の使用率がピークに達するとクラッシュします。これは、NodePortサービスを使用して SSH アクセスを多数の仮想マシン (VM) に公開する場合に発生する可能性があります。(OCPBUGS-1940)-

回避策として、

NodePortサービスを介して多数の仮想マシンに SSH アクセスを公開する場合は、OpenShift SDN クラスターネットワークプロバイダーを使用します。

-

回避策として、

バージョン 4.10 から OpenShift Virtualization 4.11 への更新は、スタンドアロンの Kubernetes NMState Operator をインストールするまでブロックされます。これは、クラスター設定が nmstate リソースを使用していない場合でも発生します。(BZ#2126537)

回避策として、以下を実施します。

クラスターにノードネットワーク設定ポリシーが定義されていないことを確認します。

$ oc get nncpOpenShift Virtualization を更新する適切な方法を選択します。

- ノードネットワーク設定ポリシーのリストが空でない場合は、この手順を終了し、Kubernetes NMState Operator をインストールして、既存の nmstate 設定を保持およびサポートします。

- リストが空の場合は、ステップ 3 に進みます。

HyperConvergedカスタムリソース (CR) にアノテーションを付けます。次のコマンドは、既存の JSON パッチを上書きします。$ oc annotate --overwrite -n openshift-cnv hco kubevirt-hyperconverged 'networkaddonsconfigs.kubevirt.io/jsonpatch=[{"op": "replace","path": "/spec/nmstate", "value": null}]'注記このパッチが適用されている間、

HyperConvergedオブジェクトはTaintedConfiguration状態をレポートします。これは無害です。- OpenShift Virtualization を更新します。

更新が完了したら、次のコマンドを実行してアノテーションを削除します。

$ oc annotate -n openshift-cnv hco kubevirt-hyperconverged networkaddonsconfigs.kubevirt.io/jsonpatch-- オプション: 上書きされた、以前に設定された JSON パッチを元に戻します。

Containerized Data Importer (CDI) によって作成された一部の永続ボリューム要求 (PVC) アノテーションにより、仮想マシンのスナップショット復元操作が無期限に停止する可能性があります。(BZ#2070366)

回避策として、アノテーションを手動で削除できます。

-

VirtualMachineSnapshotCR のstatus.virtualMachineSnapshotContentName値から、VirtualMachineSnapshotContent カスタムリソース (CR) 名を取得します。 -

VirtualMachineSnapshotContentCR を編集し、k8s.io/cloneRequestを含むすべての行を削除します。 VirtualMachineオブジェクトでspec.dataVolumeTemplatesの値を指定しなかった場合は、次の両方の条件に該当するこの namespace のDataVolumeおよびPersistentVolumeClaimオブジェクトを削除します。-

オブジェクトの名前は

restore-で始まります。 オブジェクトは仮想マシンによって参照されません。

spec.dataVolumeTemplatesの値を指定した場合、この手順はオプションとなります。

-

オブジェクトの名前は

-

更新された

VirtualMachineSnapshotCR で 復元操作 を繰り返します。

-

-

Windows 11 仮想マシンは、FIPS モード で実行されているクラスターで起動しません。Windows 11 には、デフォルトで Trusted Platform Module (TPM) デバイスが必要です。ただし、

swtpm(ソフトウェア TPM エミュレーター) パッケージは FIPS と互換性がありません。(BZ#2089301) -

Single Node OpenShift (SNO) クラスターでは、エビクションストラテジーが

LiveMigrateに設定されている共通テンプレートから作成された仮想マシンでVMCannotBeEvictedアラートが発生します。(BZ#2092412) Fedora 35 仮想マシン上の QEMU ゲストエージェントは SELinux によってブロックされ、データを報告しません。他の Fedora バージョンが影響を受ける可能性があります。(BZ#2028762)

- 回避策として、仮想マシンで SELinux を無効にし、QEMU ゲストエージェントコマンドを実行してから、SELinux を再度有効にします。

OpenShift Container Platform クラスターが OVN-Kubernetes をデフォルトの Container Network Interface (CNI) プロバイダーとして使用する場合、OVN-Kubernetes のホストネットワークトポロジーの変更により、Linux ブリッジまたはボンディングデバイスをホストのデフォルトインターフェイスに割り当てることはできません。(BZ#1885605)

- 回避策として、ホストに接続されたセカンダリーネットワークインターフェイスを使用するか、OpenShift SDN デフォルト CNI プロバイダーに切り替えることができます。

Red Hat Ceph Storage または Red Hat OpenShift Data Foundation Storage を使用する場合は、一度に 100 台以上の仮想マシンのクローンを作成できない場合があります。(BZ#1989527)

回避策として、ストレージプロファイルマニフェストに

spec.cloneStrategy: copyを設定して、ホスト支援コピーを実行できます。以下に例を示します。apiVersion: cdi.kubevirt.io/v1beta1 kind: StorageProfile metadata: name: <provisioner_class> # ... spec: claimPropertySets: - accessModes: - ReadWriteOnce volumeMode: Filesystem cloneStrategy: copy1 status: provisioner: <provisioner> storageClass: <provisioner_class>- 1

- デフォルトのクローン作成方法は

copyに設定されています。

場合によっては、複数の仮想マシンが読み取り/書き込みモードで同じ PVC をマウントできるため、データが破損する可能性があります。(BZ#1992753)

- 回避策として、複数の仮想マシンで読み取り/書き込みモードで単一の PVC を使用しないでください。

Pod Disruption Budget (PDB) は、移行可能な仮想マシンイメージについての Pod の中断を防ぎます。PDB が Pod の中断を検出する場合、

openshift-monitoringはLiveMigrateエビクションストラテジーを使用する仮想マシンイメージに対して 60 分ごとにPodDisruptionBudgetAtLimitアラートを送信します。(BZ#2026733)- 回避策として、アラートをサイレンス にします。

OpenShift Virtualization は、Pod によって使用されるサービスアカウントトークンをその特定の Pod にリンクします。OpenShift Virtualization は、トークンが含まれるディスクイメージを作成してサービスアカウントボリュームを実装します。仮想マシンを移行すると、サービスアカウントボリュームが無効になります。(BZ#2037611)

- 回避策として、サービスアカウントではなくユーザーアカウントを使用してください。ユーザーアカウントトークンは特定の Pod にバインドされていないためです。

ドライバーをインストールする前に仲介デバイスを有効にするように

HyperConvergedカスタムリソース (CR) を設定すると、新しいデバイス設定は有効になりません。この問題は更新によってトリガーされます。たとえば、NVIDIA ドライバーをインストールするdaemonsetの前にvirt-handlerを更新した場合、ノードは仮想マシン GPU を提供することができません。(BZ#2046298)回避策として、以下を実施します。

-

HyperConvergedCR からmediatedDevicesConfigurationおよびpermittedHostDevicesを削除します。 -

使用する設定で、

mediatedDevicesConfigurationおよびpermittedHostDevicesスタンザの両方を更新します。

-

csi-cloneクローンストラテジーを使用して 100 台以上の仮想マシンのクローンを作成する場合、Ceph CSI はクローンをパージしない可能性があります。クローンの手動削除も失敗する可能性があります。(BZ#2055595)-

回避策として、

ceph-mgrを再起動して仮想マシンのクローンをパージすることができます。

-

回避策として、

第5章 インストール

5.1. OpenShift Virtualization のクラスターの準備

OpenShift Virtualization をインストールする前にこのセクションを確認して、クラスターが要件を満たしていることを確認してください。

ユーザープロビジョニング、インストーラープロビジョニング、またはアシステッドインストーラーなど、任意のインストール方法を使用して、OpenShift Container Platform をデプロイできます。ただし、インストール方法とクラスタートポロジーは、スナップショットやライブマイグレーションなどの OpenShift Virtualization 機能に影響を与える可能性があります。

単一ノードの Openshift の違い

単一ノードのクラスターに OpenShift Virtualization をインストールできます。詳細は、単一ノードの Openshift について を参照してください。単一ノードの Openshift は高可用性をサポートしていないため、次の違いがあります。

- Pod disruption budgets はサポートされていません。

- ライブマイグレーション には対応していません。

-

データボリュームまたはストレージプロファイルを使用するテンプレートまたは仮想マシンには、

evictionStrategyが設定されていてはなりません。

FIPS モード

クラスターを FIPS モード でインストールする場合、OpenShift Virtualization に追加の設定は必要ありません。

IPv6

シングルスタックの IPv6 クラスターで OpenShift Virtualization は実行できません。(BZ#2193267)

5.1.1. ハードウェアとオペレーティングシステムの要件

OpenShift Virtualization の次のハードウェアおよびオペレーティングシステム要件を確認してください。

サポート対象プラットフォーム

- オンプレミスのベアメタルサーバー

- Amazon Web Services ベアメタルインスタンス。詳細は、AWS ベアメタルノードへの OpenShift Virtualization のデプロイ を参照してください。

- IBM Cloud Bare Metal Servers。詳細は IBM Cloud Bare Metal Nodes への OpenShift Virtualization のデプロイ を参照してください。

AWS ベアメタルインスタンスまたは IBM Cloud Bare Metal Servers への OpenShift Virtualization のインストールは、テクノロジープレビュー機能のみです。テクノロジープレビュー機能は、Red Hat 製品サポートのサービスレベルアグリーメント (SLA) の対象外であり、機能的に完全ではない場合があります。Red Hat は、実稼働環境でこれらを使用することを推奨していません。テクノロジープレビュー機能は、最新の製品機能をいち早く提供して、開発段階で機能のテストを行いフィードバックを提供していただくことを目的としています。

Red Hat のテクノロジープレビュー機能のサポート範囲に関する詳細は、テクノロジープレビュー機能のサポート範囲 を参照してください。

- 他のクラウドプロバイダーが提供するベアメタルインスタンスまたはサーバーはサポートされていません。

CPU の要件

- Red Hat Enterprise Linux (RHEL) 8 でサポート

- Intel 64 または AMD64 CPU 拡張機能のサポート

- Intel VT または AMD-V ハードウェア仮想化拡張機能が有効

- NX (実行なし) フラグが有効

ストレージ要件

- OpenShift Container Platform によるサポート

Red Hat OpenShift Data Foundation を使用して OpenShift Virtualization をデプロイする場合は、Windows 仮想マシンディスク用の専用ストレージクラスを作成する必要があります。詳細は 、Windows VM の ODF PersistentVolumes の最適化 を参照してください。

オペレーティングシステム要件

ワーカーノードにインストールされた Red Hat Enterprise Linux CoreOS (RHCOS)

注記RHEL ワーカー ノードはサポートされていません。

- クラスターが CPU の異なるワーカーノードを使用している場合、CPU ごとに能力が異なるため、ライブマイグレーションの失敗が発生する可能性があります。このような失敗を回避するには、各ノードに適切な能力の CPU を使用し、仮想マシンにノードアフィニティーを設定して、移行が成功するようにします。詳細は、必須のノードのアフィニティールールの設定 を参照してください。

5.1.2. 物理リソースのオーバーヘッド要件

OpenShift Virtualization は OpenShift Container Platform のアドオンであり、クラスターの計画時に考慮する必要のある追加のオーバーヘッドを強要します。各クラスターマシンは、OpenShift Container Platform の要件に加えて、以下のオーバーヘッドの要件を満たす必要があります。クラスター内の物理リソースを過剰にサブスクライブすると、パフォーマンスに影響する可能性があります。

本書に記載されている数は、Red Hat のテスト方法およびセットアップに基づいています。これらの数は、独自のセットアップおよび環境に応じて異なります。

5.1.2.1. メモリーのオーバーヘッド

以下の式を使用して、OpenShift Virtualization のメモリーオーバーヘッドの値を計算します。

クラスターメモリーのオーバーヘッド

Memory overhead per infrastructure node ≈ 150 MiBMemory overhead per worker node ≈ 360 MiBさらに、OpenShift Virtualization 環境リソースには、すべてのインフラストラクチャーノードに分散される合計 2179 MiB の RAM が必要です。

仮想マシンのメモリーオーバーヘッド

Memory overhead per virtual machine ≈ (1.002 × requested memory) \

+ 216 MiB \

+ 8 MiB × (number of vCPUs) \

+ 16 MiB × (number of graphics devices) \

+ (additional memory overhead) 5.1.2.2. CPU オーバーヘッド

以下の式を使用して、OpenShift Virtualization のクラスタープロセッサーのオーバーヘッド要件を計算します。仮想マシンごとの CPU オーバーヘッドは、個々の設定によって異なります。

クラスターの CPU オーバーヘッド

CPU overhead for infrastructure nodes ≈ 4 coresOpenShift Virtualization は、ロギング、ルーティング、およびモニタリングなどのクラスターレベルのサービスの全体的な使用率を増加させます。このワークロードに対応するには、インフラストラクチャーコンポーネントをホストするノードに、4 つの追加コア (4000 ミリコア) の容量があり、これがそれらのノード間に分散されていることを確認します。

CPU overhead for worker nodes ≈ 2 cores + CPU overhead per virtual machine仮想マシンをホストする各ワーカーノードには、仮想マシンのワークロードに必要な CPU に加えて、OpenShift Virtualization 管理ワークロード用に 2 つの追加コア (2000 ミリコア) の容量が必要です。

仮想マシンの CPU オーバーヘッド

専用の CPU が要求される場合は、仮想マシン 1 台につき CPU 1 つとなり、クラスターの CPU オーバーヘッド要件に影響が出てきます。それ以外の場合は、仮想マシンに必要な CPU の数に関する特別なルールはありません。

5.1.2.3. ストレージのオーバーヘッド

以下のガイドラインを使用して、OpenShift Virtualization 環境のストレージオーバーヘッド要件を見積もります。

クラスターストレージオーバーヘッド

Aggregated storage overhead per node ≈ 10 GiB10 GiB は、OpenShift Virtualization のインストール時にクラスター内の各ノードについてのディスク上のストレージの予想される影響に相当します。

仮想マシンのストレージオーバーヘッド

仮想マシンごとのストレージオーバーヘッドは、仮想マシン内のリソース割り当ての特定の要求により異なります。この要求は、クラスター内の別の場所でホストされるノードまたはストレージリソースの一時ストレージに対するものである可能性があります。OpenShift Virtualization は現在、実行中のコンテナー自体に追加の一時ストレージを割り当てていません。

5.1.2.4. 例

クラスター管理者が、クラスター内の 10 台の (それぞれ 1 GiB の RAM と 2 つの vCPU の) 仮想マシンをホストする予定の場合、クラスター全体で影響を受けるメモリーは 11.68 GiB になります。クラスターの各ノードについて予想されるディスク上のストレージの影響は 10 GiB で示され、仮想マシンのワークロードをホストするワーカーノードについての CPU の影響は最小 2 コアで示されます。

5.1.3. オブジェクトの最大値

クラスターを計画するときは、次のテスト済みオブジェクトの最大数を考慮する必要があります。

5.1.4. 制限されたネットワーク環境

インターネット接続のない制限された環境に OpenShift Virtualization をインストールする場合は、制限されたネットワーク用に Operator Lifecycle Manager を設定 する必要があります。

インターネット接続が制限されている場合、Operator Lifecycle Manager でプロキシーサポートを設定 して、Red Hat が提供する OperatorHub にアクセスすることができます。

5.1.5. ライブマイグレーション

ライブマイグレーションには次の要件があります。

-

ReadWriteMany(RWX) アクセスモードの共有ストレージ - 十分な RAM およびネットワーク帯域幅

- 仮想マシンがホストモデルの CPU を使用する場合、ノードは仮想マシンのホストモデルの CPU をサポートする必要があります。

ライブマイグレーションを引き起こすノードドレインをサポートするために、クラスター内に十分なメモリーリクエスト容量があることを確認する必要があります。以下の計算を使用して、必要な予備のメモリーを把握できます。

Product of (Maximum number of nodes that can drain in parallel) and (Highest total VM memory request allocations across nodes)クラスターで 並行して実行できるデフォルトの移行数 は 5 です。

5.1.6. スナップショットとクローン作成

スナップショットとクローン作成の要件は、OpenShift Virtualization ストレージ機能 を参照してください。

5.1.7. クラスターの高可用性オプション

クラスターには、次の高可用性 (HA) オプションのいずれかを設定できます。

インストーラーによってプロビジョニングされたインフラストラクチャー (IPI) の 自動高可用性は、マシンの可用性チェック をデプロイすることで利用できます。

注記インストーラーでプロビジョニングされるインフラストラクチャーを使用してインストールされ、MachineHealthCheck が適切に設定された OpenShift Container Platform クラスターで、ノードで MachineHealthCheck が失敗し、クラスターで利用できなくなると、そのノードは再利用されます。障害が発生したノードで実行された仮想マシンでは、一連の条件によって次に起こる動作が変わります。潜在的な結果と RunStrategy がそれらの結果にどのように影響するかについての詳細情報は、仮想マシンの RunStrategies について を参照してください。

IPI と非 IPI の両方の自動高可用性は、OpenShift Container Platform クラスターで Node Health Check Operator を使用して

NodeHealthCheckコントローラーをデプロイすることで利用できます。コントローラーは異常なノードを識別し、セルフノード修復 Operator を使用して異常なノードを修復します。重要Node Health Check Operator は、テクノロジープレビュー機能のみです。テクノロジープレビュー機能は、Red Hat 製品サポートのサービスレベルアグリーメント (SLA) の対象外であり、機能的に完全ではない場合があります。Red Hat は、実稼働環境でこれらを使用することを推奨していません。テクノロジープレビュー機能は、最新の製品機能をいち早く提供して、開発段階で機能のテストを行いフィードバックを提供していただくことを目的としています。

Red Hat のテクノロジープレビュー機能のサポート範囲に関する詳細は、テクノロジープレビュー機能のサポート範囲 を参照してください。

モニタリングシステムまたは有資格者を使用してノードの可用性をモニターすることにより、あらゆるプラットフォームの高可用性を利用できます。ノードが失われた場合は、これをシャットダウンして

oc delete node <lost_node>を実行します。注記外部モニタリングシステムまたは資格のある人材によるノードの正常性の監視が行われない場合、仮想マシンは高可用性を失います。

5.2. OpenShift Virtualization コンポーネントのノードの指定

ノードの配置ルールを設定して、OpenShift Virtualization Operator、ワークロード、およびコントローラーをデプロイするノードを指定します。

OpenShift Virtualization のインストール後に一部のコンポーネントのノードの配置を設定できますが、ワークロード用にノードの配置を設定する場合には仮想マシンを含めることはできません。

5.2.1. 仮想化コンポーネントのノード配置について

OpenShift Virtualization がそのコンポーネントをデプロイする場所をカスタマイズして、以下を確認する必要がある場合があります。

- 仮想マシンは、仮想化ワークロード用のノードにのみデプロイされる。

- Operator はインフラストラクチャーノードにのみデプロイされる。

- 特定のノードは OpenShift Virtualization の影響を受けない。たとえば、クラスターで実行される仮想化に関連しないワークロードがあり、それらのワークロードを OpenShift Virtualization から分離する必要があるとします。

5.2.1.1. ノードの配置ルールを仮想化コンポーネントに適用する方法

対応するオブジェクトを直接編集するか、Web コンソールを使用して、コンポーネントのノードの配置ルールを指定できます。

-

Operator Lifecycle Manager (OLM) がデプロイする OpenShift Virtualization Operator の場合は、OLM

Subscriptionオブジェクトを直接編集します。現時点では、Web コンソールを使用してSubscriptionオブジェクトのノードの配置ルールを設定することはできません。 -

OpenShift Virtualization Operator がデプロイするコンポーネントの場合は、

HyperConvergedオブジェクトを直接編集するか、OpenShift Virtualization のインストール時に Web コンソールを使用してこれを設定します。 ホストパスプロビジョナーの場合、

HostPathProvisionerオブジェクトを直接編集するか、Web コンソールを使用してこれを設定します。警告ホストパスプロビジョナーと仮想化コンポーネントを同じノードでスケジュールする必要があります。スケジュールしない場合は、ホストパスプロビジョナーを使用する仮想化 Pod を実行できません。

オブジェクトに応じて、以下のルールタイプを 1 つ以上使用できます。

nodeSelector- Pod は、キーと値のペアまたはこのフィールドで指定したペアを使用してラベルが付けられたノードに Pod をスケジュールできます。ノードには、リスト表示されたすべてのペアに一致するラベルがなければなりません。

affinity- より表現的な構文を使用して、ノードと Pod に一致するルールを設定できます。アフィニティーを使用すると、ルールの適用方法に追加のニュアンスを持たせることができます。たとえば、ルールがハード要件ではなく基本設定になるように指定し、ルールの条件が満たされない場合も Pod がスケジュールされるようにすることができます。

tolerations- 一致するテイントを持つノードで Pod をスケジュールできます。テイントがノードに適用される場合、そのノードはテイントを容認する Pod のみを受け入れます。

5.2.1.2. OLM Subscription オブジェクトのノード配置

OLM が OpenShift Virtualization Operator をデプロイするノードを指定するには、OpenShift Virtualization のインストール時に Subscription オブジェクトを編集します。以下の例に示されるように、spec.config フィールドにノードの配置ルールを追加できます。

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: hco-operatorhub

namespace: openshift-cnv

spec:

source: redhat-operators

sourceNamespace: openshift-marketplace

name: kubevirt-hyperconverged

startingCSV: kubevirt-hyperconverged-operator.v4.11.8

channel: "stable"

config: - 1

configフィールドはnodeSelectorおよびtolerationsをサポートしますが、affinityはサポートしません。

5.2.1.3. HyperConverged オブジェクトのノード配置

OpenShift Virtualization がそのコンポーネントをデプロイするノードを指定するには、OpenShift Virtualization のインストール時に作成する HyperConverged Cluster カスタムリソース (CR) ファイルに nodePlacement オブジェクトを含めることができます。以下の例のように、spec.infra および spec.workloads フィールドに nodePlacement を含めることができます。

apiVersion: hco.kubevirt.io/v1beta1

kind: HyperConverged

metadata:

name: kubevirt-hyperconverged

namespace: openshift-cnv

spec:

infra:

nodePlacement:

...

workloads:

nodePlacement:

...- 1

nodePlacementフィールドは、nodeSelector、affinity、およびtolerationsフィールドをサポートします。

5.2.1.4. HostPathProvisioner オブジェクトのノード配置

ノードの配置ルールは、ホストパスプロビジョナーのインストール時に作成する HostPathProvisioner オブジェクトの spec.workload フィールドで設定できます。

apiVersion: hostpathprovisioner.kubevirt.io/v1beta1

kind: HostPathProvisioner

metadata:

name: hostpath-provisioner

spec:

imagePullPolicy: IfNotPresent

pathConfig:

path: "</path/to/backing/directory>"

useNamingPrefix: false

workload: - 1

workloadフィールドは、nodeSelector、affinity、およびtolerationsフィールドをサポートします。

5.2.2. マニフェストの例

以下の YAML ファイルの例では、nodePlacement、affinity、および tolerations オブジェクトを使用して OpenShift Virtualization コンポーネントのノード配置をカスタマイズします。

5.2.2.1. Operator Lifecycle Manager サブスクリプションオブジェクト

5.2.2.1.1. 例: OLM Subscription オブジェクトの nodeSelector を使用したノード配置

この例では、OLM が example.io/example-infra-key = example-infra-value のラベルが付けられたノードに OpenShift Virtualization Operator を配置するように、nodeSelector を設定します。

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: hco-operatorhub

namespace: openshift-cnv

spec:

source: redhat-operators

sourceNamespace: openshift-marketplace

name: kubevirt-hyperconverged

startingCSV: kubevirt-hyperconverged-operator.v4.11.8

channel: "stable"

config:

nodeSelector:

example.io/example-infra-key: example-infra-value5.2.2.1.2. 例: OLM Subscription オブジェクトの容認を使用したノード配置

この例では、OLM が OpenShift Virtualization Operator をデプロイするために予約されるノードには key=virtualization:NoSchedule テイントのラベルが付けられます。一致する容認のある Pod のみがこれらのノードにスケジュールされます。

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: hco-operatorhub

namespace: openshift-cnv

spec:

source: redhat-operators

sourceNamespace: openshift-marketplace

name: kubevirt-hyperconverged

startingCSV: kubevirt-hyperconverged-operator.v4.11.8

channel: "stable"

config:

tolerations:

- key: "key"

operator: "Equal"

value: "virtualization"

effect: "NoSchedule"5.2.2.2. HyperConverged オブジェクト

5.2.2.2.1. 例: HyperConverged Cluster CR の nodeSelector を使用したノード配置

この例では、nodeSelector は、インフラストラクチャーリソースが example.io/example-infra-key = example-infra-value のラベルが付けられたノードに配置されるように設定され、ワークロードは example.io/example-workloads-key = example-workloads-value のラベルが付けられたノードに配置されるように設定されます。

apiVersion: hco.kubevirt.io/v1beta1

kind: HyperConverged

metadata:

name: kubevirt-hyperconverged

namespace: openshift-cnv

spec:

infra:

nodePlacement:

nodeSelector:

example.io/example-infra-key: example-infra-value

workloads:

nodePlacement:

nodeSelector:

example.io/example-workloads-key: example-workloads-value5.2.2.2.2. 例: HyperConverged Cluster CR のアフィニティーを使用したノード配置

この例では、affinity は、インフラストラクチャーリソースが example.io/example-infra-key = example-infra-value のラベルが付けられたノードに配置されるように設定され、ワークロードが example.io/example-workloads-key = example-workloads-value のラベルが付けられたノードに配置されるように設定されます。ワークロード用には 9 つ以上の CPU を持つノードが優先されますが、それらが利用可能ではない場合も、Pod は依然としてスケジュールされます。

apiVersion: hco.kubevirt.io/v1beta1

kind: HyperConverged

metadata:

name: kubevirt-hyperconverged

namespace: openshift-cnv

spec:

infra:

nodePlacement:

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

nodeSelectorTerms:

- matchExpressions:

- key: example.io/example-infra-key

operator: In

values:

- example-infra-value

workloads:

nodePlacement:

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

nodeSelectorTerms:

- matchExpressions:

- key: example.io/example-workloads-key

operator: In

values:

- example-workloads-value

preferredDuringSchedulingIgnoredDuringExecution:

- weight: 1

preference:

matchExpressions:

- key: example.io/num-cpus

operator: Gt

values:

- 85.2.2.2.3. 例: HyperConverged Cluster CR の容認を使用したノード配置

この例では、OpenShift Virtualization コンポーネント用に予約されるノードには key=virtualization:NoSchedule テイントのラベルが付けられます。一致する容認のある Pod のみがこれらのノードにスケジュールされます。

apiVersion: hco.kubevirt.io/v1beta1

kind: HyperConverged

metadata:

name: kubevirt-hyperconverged

namespace: openshift-cnv

spec:

workloads:

nodePlacement:

tolerations:

- key: "key"

operator: "Equal"

value: "virtualization"

effect: "NoSchedule"5.2.2.3. HostPathProvisioner オブジェクト

5.2.2.3.1. 例: HostPathProvisioner オブジェクトの nodeSelector を使用したノード配置

この例では、example.io/example-workloads-key = example-workloads-value のラベルが付けられたノードにワークロードが配置されるように nodeSelector を設定します。

apiVersion: hostpathprovisioner.kubevirt.io/v1beta1

kind: HostPathProvisioner

metadata:

name: hostpath-provisioner

spec:

imagePullPolicy: IfNotPresent

pathConfig:

path: "</path/to/backing/directory>"

useNamingPrefix: false

workload:

nodeSelector:

example.io/example-workloads-key: example-workloads-value5.3. Web コンソールを使用した OpenShift Virtualization のインストール

OpenShift Virtualization をインストールし、仮想化機能を OpenShift Container Platform クラスターに追加します。

OpenShift Container Platform 4.11 web console を使用して、OpenShift Virtualization Operator にサブスクライブし、これをデプロイすることができます。

5.3.1. OpenShift Virtualization Operator のインストール

OpenShift Container Platform Web コンソールから OpenShift Virtualization Operator をインストールできます。

前提条件

- OpenShift Container Platform 4.11 をクラスターにインストールしていること。

-

cluster-adminパーミッションを持つユーザーとして OpenShift Container Platform Web コンソールにログインすること。

手順

- Administrator パースペクティブから、Operators → OperatorHub をクリックします。

- Filter by keyword に Virtualization と入力します。

- Red Hat ソースラベルをがある {CNVOperatorDisplayName} タイルを選択します。

- Operator についての情報を確認してから、Install をクリックします。

Install Operator ページで以下を行います。

- 選択可能な Update Channel オプションの一覧から stable を選択します。これにより、OpenShift Container Platform バージョンと互換性がある OpenShift Virtualization のバージョンをインストールすることができます。

インストールされた namespace の場合、Operator recommended namespace オプションが選択されていることを確認します。これにより、Operator が必須の

openshift-cnvnamespace にインストールされます。この namespace は存在しない場合は、自動的に作成されます。警告OpenShift Virtualization Operator を

openshift-cnv以外の namespace にインストールしようとすると、インストールが失敗します。Approval Strategy の場合に、stable 更新チャネルで新しいバージョンが利用可能になったときに OpenShift Virtualization が自動更新されるように、デフォルト値である Automaticを選択することを強く推奨します。

Manual 承認ストラテジーを選択することは可能ですが、クラスターのサポート容易性および機能に対応するリスクが高いため、推奨できません。これらのリスクを完全に理解していて、Automatic を使用できない場合のみ、Manual を選択してください。

警告OpenShift Virtualization は対応する OpenShift Container Platform バージョンで使用される場合にのみサポートされるため、OpenShift Virtualization が更新されないと、クラスターがサポートされなくなる可能性があります。

-

Install をクリックし、Operator を

openshift-cnvnamespace で利用可能にします。 - Operator が正常にインストールされたら、Create HyperConverged をクリックします。

- オプション: OpenShift Virtualization コンポーネントの Infra および Workloads ノード配置オプションを設定します。

- Create をクリックして OpenShift Virtualization を起動します。

検証

- Workloads → Pods ページに移動して、OpenShift Virtualization Pod がすべて Running 状態になるまでこれらの Pod をモニターします。すべての Pod で Running 状態が表示された後に、OpenShift Virtualization を使用できます。

5.3.2. 次のステップ

以下のコンポーネントを追加で設定する必要がある場合があります。

- ホストパスプロビジョナー は、OpenShift Virtualization 用に設計されたローカルストレージプロビジョナーです。仮想マシンのローカルストレージを設定する必要がある場合、まずホストパスプロビジョナーを有効にする必要があります。

5.4. CLI を使用した OpenShift Virtualization のインストール

OpenShift Virtualization をインストールし、仮想化機能を OpenShift Container Platform クラスターに追加します。コマンドラインを使用してマニフェストをクラスターに適用し、OpenShift Virtualization Operator にサブスクライブし、デプロイできます。

OpenShift Virtualization がそのコンポーネントをインストールするノードを指定するには、ノードの配置ルールを設定 します。

5.4.1. 前提条件

- OpenShift Container Platform 4.11 をクラスターにインストールしていること。

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-admin権限を持つユーザーとしてログインしている。

5.4.2. CLI を使用した OpenShift Virtualization カタログのサブスクライブ

OpenShift Virtualization をインストールする前に、OpenShift Virtualization カタログにサブスクライブする必要があります。サブスクライブにより、openshift-cnv namespace に OpenShift Virtualization Operator へのアクセスが付与されます。

単一マニフェストをクラスターに適用して Namespace、OperatorGroup、および Subscription オブジェクトをサブスクライブし、設定します。

手順

以下のマニフェストを含む YAML ファイルを作成します。

apiVersion: v1 kind: Namespace metadata: name: openshift-cnv --- apiVersion: operators.coreos.com/v1 kind: OperatorGroup metadata: name: kubevirt-hyperconverged-group namespace: openshift-cnv spec: targetNamespaces: - openshift-cnv --- apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: hco-operatorhub namespace: openshift-cnv spec: source: redhat-operators sourceNamespace: openshift-marketplace name: kubevirt-hyperconverged startingCSV: kubevirt-hyperconverged-operator.v4.11.8 channel: "stable"1 - 1

stableチャネルを使用することで、OpenShift Container Platform バージョンと互換性のある OpenShift Virtualization のバージョンをインストールすることができます。

以下のコマンドを実行して、OpenShift Virtualization に必要な

Namespace、OperatorGroup、およびSubscriptionオブジェクトを作成します。$ oc apply -f <file name>.yaml

YAML ファイルで、証明書のローテーションパラメーターを設定 できます。

5.4.3. CLI を使用した OpenShift Virtualization Operator のデプロイ

oc CLI を使用して OpenShift Virtualization Operator をデプロイすることができます。

前提条件

-

openshift-cnvnamespace の OpenShift Virtualization カタログへのアクティブなサブスクリプション。

手順

以下のマニフェストを含む YAML ファイルを作成します。

apiVersion: hco.kubevirt.io/v1beta1 kind: HyperConverged metadata: name: kubevirt-hyperconverged namespace: openshift-cnv spec:以下のコマンドを実行して OpenShift Virtualization Operator をデプロイします。

$ oc apply -f <file_name>.yaml

検証

openshift-cnvnamespace の Cluster Service Version (CSV) のPHASEを監視して、OpenShift Virtualization が正常にデプロイされたことを確認します。以下のコマンドを実行します。$ watch oc get csv -n openshift-cnv以下の出力は、デプロイメントに成功したかどうかを表示します。

出力例

NAME DISPLAY VERSION REPLACES PHASE kubevirt-hyperconverged-operator.v4.11.8 OpenShift Virtualization 4.11.8 Succeeded

5.4.4. 次のステップ

以下のコンポーネントを追加で設定する必要がある場合があります。

- ホストパスプロビジョナー は、OpenShift Virtualization 用に設計されたローカルストレージプロビジョナーです。仮想マシンのローカルストレージを設定する必要がある場合、まずホストパスプロビジョナーを有効にする必要があります。

5.5. virtctl クライアントの有効化

virtctl クライアントは、OpenShift Virtualization リソースを管理するためのコマンドラインユーティリティーです。これは、Linux、macOS、および Windows ディストリビューションで利用できます。

5.5.1. virtctl クライアントのダウンロードおよびインストール

5.5.1.1. virtctl クライアントのダウンロード

ConsoleCLIDownload カスタムリソース (CR) で提供されるリンクを使用して virtctl クライアントをダウンロードします。

手順

以下のコマンドを実行して

ConsoleCLIDownloadオブジェクトを表示します。$ oc get ConsoleCLIDownload virtctl-clidownloads-kubevirt-hyperconverged -o yaml-

お使いのディストリビューションにリスト表示されているリンクを使用して

virtctlクライアントをダウンロードします。

5.5.1.2. virtctl クライアントのインストール

オペレーティングシステムに適した場所からダウンロードした後に、virtctl クライアントをデプロイメントし、インストールします。

前提条件

-

virtctlクライアントをダウンロードしている。

手順

Linux の場合

tarball を展開します。以下の CLI コマンドは、tarball と同じディレクトリーにデプロイメントします。

$ tar -xvf <virtctl-version-distribution.arch>.tar.gzデプロイメントしたフォルダー階層に移動し、以下のコマンドを実行して

virtctlバイナリーを実行可能にします。$ chmod +x <virtctl-file-name>-

virtctlバイナリーをPATH 環境変数にあるディレクトリーに移動します。 パスを確認するには、以下のコマンドを実行します。

$ echo $PATH

Windows ユーザーの場合:

- アーカイブを展開し、解凍します。

-

展開したフォルダー階層に移動し、

virtctl実行可能ファイルをダブルクリックしてクライアントをインストールします。 -

virtctlバイナリーをPATH 環境変数にあるディレクトリーに移動します。 パスを確認するには、以下のコマンドを実行します。

C:\> path

macOS ユーザーの場合:

- アーカイブを展開し、解凍します。

-

virtctlバイナリーをPATH 環境変数にあるディレクトリーに移動します。 パスを確認するには、以下のコマンドを実行します。

echo $PATH

5.5.2. virtctl RPM パッケージのインストール

OpenShift Virtualization リポジトリーを有効にした後、virtctl クライアントを RPM としてインストールできます。

5.5.2.1. OpenShift Virtualization リポジトリーの有効化

Red Hat Enterprise Linux (RHEL) のバージョンの OpenShift Virtualization リポジトリーを有効にします。

前提条件

- システムは、Red Hat Container Native Virtualization エンタイトルメントへの有効なサブスクリプションを持つ Red Hat アカウントに登録されています。

手順

subscription-managerCLI ツールを使用して、オペレーティングシステムに適切な OpenShift Virtualization リポジトリーを有効にします。RHEL 8 のリポジトリーを有効にするには、次を実行します。

# subscription-manager repos --enable cnv-4.11-for-rhel-8-x86_64-rpmsRHEL 7 のリポジトリーを有効にするには、次を実行します。

# subscription-manager repos --enable rhel-7-server-cnv-4.11-rpms

5.5.2.2. yum ユーティリティーを使用した virtctl クライアントのインストール

kubevirt-virtctl パッケージから virtctl クライアントをインストールします。

前提条件

- Red Hat Enterprise Linux (RHEL) システムで OpenShift Virtualization リポジトリーを有効にしました。

手順

kubevirt-virtctlパッケージをインストールします。# yum install kubevirt-virtctl

5.6. OpenShift Virtualization のアンインストール

Web コンソールまたはコマンドラインインターフェイス (CLI) を使用して OpenShift Virtualization をアンインストールし、OpenShift Virtualization ワークロード、Operator、およびそのリソースを削除します。

5.6.1. Web コンソールを使用した OpenShift Virtualization のアンインストール

Web コンソール を使用して OpenShift Virtualization をアンインストールし、以下のタスクを実行します。

最初に、すべての 仮想マシン、仮想マシンインスタンス、および データボリューム を削除する必要があります。

ワークロードがクラスターに残っている間は、OpenShift Virtualization をアンインストールできません。

5.6.1.1. HyperConverged カスタムリソースの削除

OpenShift Virtualization をアンインストールするには、最初に HyperConverged カスタムリソース (CR) を削除します。

前提条件

-

cluster-admin権限を持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできる。

手順

- Operators → Installed Operators ページに移動します。

- OpenShift Virtualization Operator を選択します。

- OpenShift Virtualization Deployment タブをクリックします。

-

kubevirt-hyperconvergedの横にある Options メニュー をクリックし、Delete HyperConverged を選択します。

をクリックし、Delete HyperConverged を選択します。

- 確認ウィンドウで Delete をクリックします。

5.6.1.2. Web コンソールの使用によるクラスターからの Operator の削除

クラスター管理者は Web コンソールを使用して、選択した namespace からインストールされた Operator を削除できます。

前提条件

-

cluster-adminパーミッションを持つアカウントを使用して OpenShift Container Platform クラスター Web コンソールにアクセスできる。

手順

- Operators → Installed Operators ページに移動します。

- スクロールするか、キーワードを Filter by name フィールドに入力して、削除する Operator を見つけます。次に、それをクリックします。

Operator Details ページの右側で、Actions 一覧から Uninstall Operator を選択します。

Uninstall Operator? ダイアログボックスが表示されます。

Uninstall を選択し、Operator、Operator デプロイメント、および Pod を削除します。このアクションの後には、Operator は実行を停止し、更新を受信しなくなります。

注記このアクションは、カスタムリソース定義 (CRD) およびカスタムリソース (CR) など、Operator が管理するリソースは削除されません。Web コンソールおよび継続して実行されるクラスター外のリソースによって有効にされるダッシュボードおよびナビゲーションアイテムには、手動でのクリーンアップが必要になる場合があります。Operator のアンインストール後にこれらを削除するには、Operator CRD を手動で削除する必要があります。

5.6.1.3. Web コンソールを使用した namespace の削除

OpenShift Container Platform Web コンソールを使用して namespace を削除できます。

前提条件

-

cluster-admin権限を持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできる。

手順

- Administration → Namespaces に移動します。

- namespace の一覧で削除する必要のある namespace を見つけます。

-

namespace の一覧の右端で、Options メニュー

から Delete Namespace を選択します。

から Delete Namespace を選択します。

- Delete Namespace ペインが表示されたら、フィールドから削除する namespace の名前を入力します。

- Delete をクリックします。

5.6.1.4. OpenShift Virtualization カスタムリソース定義の削除

Web コンソールを使用して、OpenShift Virtualization カスタムリソース定義 (CRD) を削除できます。

前提条件

-

cluster-admin権限を持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできる。

手順

- Administration → CustomResourceDefinitions に移動します。

-

Label フィルターを選択し、Search フィールドに

operators.coreos.com/kubevirt-hyperconverged.openshift-cnvと入力して OpenShift Virtualization CRD を表示します。 -

各 CRD の横にある Options メニュー

をクリックし、Delete CustomResourceDefinition の削除を選択します。

をクリックし、Delete CustomResourceDefinition の削除を選択します。

5.6.2. CLI を使用した OpenShift Virtualization のアンインストール

コマンドラインインターフェイス (CLI) を使用して OpenShift Virtualization をアンインストールできます。

前提条件

-

cluster-admin権限を持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできる。 - OpenShift CLI (oc) がインストールされている。

- すべての 仮想マシン、仮想マシンインスタンス、および データボリューム を削除しました。ワークロードがクラスターに残っている間は、OpenShift Virtualization をアンインストールできません。

手順

HyperConvergedカスタムリソースを削除します。$ oc delete HyperConverged kubevirt-hyperconverged -n openshift-cnvOpenShift Virtualization Operator サブスクリプションを削除します。

$ oc delete subscription kubevirt-hyperconverged -n openshift-cnvOpenShift Virtualization

ClusterServiceVersionリソースを削除します。$ oc delete csv -n openshift-cnv -l operators.coreos.com/kubevirt-hyperconverged.openshift-cnvOpenShift Virtualization namespace を削除します。

$ oc delete namespace openshift-cnvdry-runオプションを指定してoc delete crdコマンドを実行し、OpenShift Virtualization カスタムリソース定義 (CRD) を一覧表示します。$ oc delete crd --dry-run=client -l operators.coreos.com/kubevirt-hyperconverged.openshift-cnv出力例

customresourcedefinition.apiextensions.k8s.io "cdis.cdi.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "hostpathprovisioners.hostpathprovisioner.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "hyperconvergeds.hco.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "kubevirts.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "networkaddonsconfigs.networkaddonsoperator.network.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "ssps.ssp.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "tektontasks.tektontasks.kubevirt.io" deleted (dry run)dry-runオプションを指定せずにoc delete crdコマンドを実行して、CRD を削除します。$ oc delete crd -l operators.coreos.com/kubevirt-hyperconverged.openshift-cnv

第6章 OpenShift Virtualization の更新

Operator Lifecycle Manager(OLM) が OpenShift Virtualization の z-stream およびマイナーバージョンの更新を提供する方法を確認します。

Node Maintenance Operator (NMO) は OpenShift Virtualization に同梱されなくなりました。これは、OpenShift Container Platform Web コンソールの OperatorHub から NMO をインストール、または OpenShift CLI (

oc) を使用してインストールできます。OpenShift Virtualization 4.10.2 以降のリリースから OpenShift Virtualization 4.11 に更新する前に、以下のいずれかのタスクを実行する必要があります。

- すべてのノードをメンテナンスモードから移動します。

-

スタンドアロン NMO をインストールし、

nodemaintenances.nodemaintenance.kubevirt.ioカスタムリソース (CR) をnodemaintenances.nodemaintenance.medik8s.ioCR に置き換えます。

6.1. OpenShift Virtualization の更新について

- Operator Lifecycle Manager(OLM) は OpenShift Virtualization Operator のライフサイクルを管理します。OpenShift Container Platform のインストール時にデプロイされる Marketplace Operator により、クラスターで外部 Operator が利用できるようになります。

- OLM は、OpenShift Virtualization の z-stream およびマイナーバージョンの更新を提供します。OpenShift Container Platform を次のマイナーバージョンに更新すると、マイナーバージョンの更新が利用可能になります。OpenShift Container Platform を最初に更新しない限り、OpenShift Virtualization を次のマイナーバージョンに更新できません。

- OpenShift Virtualization サブスクリプションは、stable という名前の単一の更新チャネルを使用します。stable チャネルでは、OpenShift Virtualization および OpenShift Container Platform バージョンとの互換性が確保されます。

サブスクリプションの承認ストラテジーが Automatic に設定されている場合に、更新プロセスは、Operator の新規バージョンが stable チャネルで利用可能になるとすぐに開始します。サポート可能な環境を確保するために、自動 承認ストラテジーを使用することを強く推奨します。OpenShift Virtualization の各マイナーバージョンは、対応する OpenShift Container Platform バージョンを実行する場合にのみサポートされます。たとえば、OpenShift Virtualization 4.11 は OpenShift Container Platform 4.11 で実行する必要があります。

- クラスターのサポート容易性および機能が損なわれるリスクがあるので、Manual 承認ストラテジーを選択することは可能ですが、推奨していません。Manual 承認ストラテジーでは、保留中のすべての更新を手動で承認する必要があります。OpenShift Container Platform および OpenShift Virtualization の更新の同期が取れていない場合には、クラスターはサポートされなくなります。

- 更新の完了までにかかる時間は、ネットワーク接続によって異なります。ほとんどの自動更新は 15 分以内に完了します。

- Open Shift Virtualization を更新しても、ネットワーク接続が中断されることはありません。

- データボリュームおよびその関連付けられた永続ボリューム要求 (PVC) は更新時に保持されます。

ホストパスプロビジョナーストレージを使用する仮想マシンを実行している場合、それらをライブマイグレーションすることはできず、Open Shift Container Platform クラスターの更新をブロックする可能性があります。

回避策として、仮想マシンを再設定し、クラスターの更新時にそれらの電源を自動的にオフになるようにできます。evictionStrategy: LiveMigrate フィールドを削除し、runStrategy フィールドを Always に設定します。

6.2. ワークロードの自動更新の設定

6.2.1. ワークロードの更新について

OpenShift Virtualization を更新すると、ライブマイグレーションをサポートしている場合には libvirt、virt-launcher、および qemu などの仮想マシンのワークロードが自動的に更新されます。

各仮想マシンには、仮想マシンインスタンス (VMI) を実行する virt-launcher Pod があります。virt-launcher Pod は、仮想マシン (VM) のプロセスを管理するために使用される libvirt のインスタンスを実行します。

HyperConverged カスタムリソース (CR) の spec.workloadUpdateStrategy スタンザを編集して、ワークロードの更新方法を設定できます。ワークロードの更新方法として、LiveMigrate と Evict の 2 つが利用可能です。

Evictメソッドは VMI Pod をシャットダウンするため、デフォルトではLiveMigrate更新ストラテジーのみが有効になっています。

LiveMigrateが有効な唯一の更新ストラテジーである場合:

- ライブマイグレーションをサポートする VMI は更新プロセス時に移行されます。VM ゲストは、更新されたコンポーネントが有効になっている新しい Pod に移動します。

ライブマイグレーションをサポートしない VMI は中断または更新されません。

-

VMI に

LiveMigrateエビクションストラテジーがあるが、ライブマイグレーションをサポートしていない場合、VMI は更新されません。

-

VMI に

LiveMigrateとEvictの両方を有効にした場合:

-

ライブマイグレーションをサポートする VMI は、

LiveMigrate更新ストラテジーを使用します。 -

ライブマイグレーションをサポートしない VMI は、

Evict更新ストラテジーを使用します。VMI が、runStrategyの値がalwaysであるVirtualMachineオブジェクトによって制御されている場合、新しい VMI は、コンポーネントが更新された新しい Pod に作成されます。

移行の試行とタイムアウト

ワークロードを更新するときに、Pod が次の期間Pending状態の場合、ライブマイグレーションは失敗します。

- 5 分間

-

Pod が

Unschedulableであるために保留中の場合。 - 15 分

- 何らかの理由で Pod が保留状態のままになっている場合。

VMI が移行に失敗すると、 virt-controllerは VMI の移行を再試行します。すべての移行可能な VMI が新しいvirt-launcher Pod で実行されるまで、このプロセスが繰り返されます。ただし、VMI が不適切に設定されている場合、これらの試行は無限に繰り返される可能性があります。

各試行は、移行オブジェクトに対応します。直近の 5 回の試行のみがバッファーに保持されます。これにより、デバッグ用の情報を保持しながら、移行オブジェクトがシステムに蓄積されるのを防ぎます。

6.2.2. ワークロードの更新方法の設定

HyperConvergedカスタムリソース (CR) を編集することにより、ワークロードの更新方法を設定できます。

前提条件

ライブマイグレーションを更新方法として使用するには、まずクラスターでライブマイグレーションを有効にする必要があります。

注記VirtualMachineInstanceCR にevictionStrategy: LiveMigrateが含まれており、仮想マシンインスタンス (VMI) がライブマイグレーションをサポートしない場合には、VMI は更新されません。

手順

デフォルトエディターで

HyperConvergedCR を作成するには、以下のコマンドを実行します。$ oc edit hco -n openshift-cnv kubevirt-hyperconvergedHyperConvergedCR のworkloadUpdateStrategyスタンザを編集します。以下に例を示します。apiVersion: hco.kubevirt.io/v1beta1 kind: HyperConverged metadata: name: kubevirt-hyperconverged spec: workloadUpdateStrategy: workloadUpdateMethods:1 - LiveMigrate2 - Evict3 batchEvictionSize: 104 batchEvictionInterval: "1m0s"5 ...- 1

- ワークロードの自動更新を実行するのに使用できるメソッド。設定可能な値は

LiveMigrateおよびEvictです。上記の例のように両方のオプションを有効にした場合に、ライブマイグレーションをサポートする VMI にはLiveMigrateを、ライブマイグレーションをサポートしない VMI にはEvictを、更新に使用します。ワークロードの自動更新を無効にするには、workloadUpdateStrategyスタンザを削除するか、workloadUpdateMethods: []を設定して配列を空のままにします。 - 2

- 中断を最小限に抑えた更新メソッド。ライブマイグレーションをサポートする VMI は、仮想マシン (VM) ゲストを更新されたコンポーネントが有効なっている新規 Pod に移行することで更新されます。

LiveMigrateがリストされている唯一のワークロード更新メソッドである場合には、ライブマイグレーションをサポートしない VMI は中断または更新されません。 - 3

- アップグレード時に VMI Pod をシャットダウンする破壊的な方法。

Evictは、ライブマイグレーションがクラスターで有効でない場合に利用可能な唯一の更新方法です。VMI がrunStrategy: alwaysに設定されたVirtualMachineオブジェクトによって制御される場合には、新規の VMI は、更新されたコンポーネントを使用して新規 Pod に作成されます。 - 4

Evictメソッドを使用して一度に強制的に更新できる VMI の数。これは、LiveMigrateメソッドには適用されません。- 5

- 次のワークロードバッチをエビクトするまで待機する間隔。これは、

LiveMigrateメソッドには適用されません。

注記HyperConvergedCR のspec.liveMigrationConfigスタンザを編集することにより、ライブマイグレーションの制限とタイムアウトを設定できます。- 変更を適用するには、エディターを保存し、終了します。

6.3. 保留中の Operator 更新の承認

6.3.1. 保留中の Operator 更新の手動による承認

インストールされた Operator のサブスクリプションの承認ストラテジーが Manual に設定されている場合、新規の更新が現在の更新チャネルにリリースされると、インストールを開始する前に更新を手動で承認する必要があります。

前提条件

- Operator Lifecycle Manager (OLM) を使用して以前にインストールされている Operator。

手順

- OpenShift Container Platform Web コンソールの Administrator パースペクティブで、Operators → Installed Operators に移動します。

- 更新が保留中の Operator は Upgrade available のステータスを表示します。更新する Operator の名前をクリックします。

- Subscription タブをクリックします。承認が必要な更新は、アップグレードステータス の横に表示されます。たとえば、1 requires approval が表示される可能性があります。

- 1 requires approval をクリックしてから、Preview Install Plan をクリックします。

- 更新に利用可能なリソースとして一覧表示されているリソースを確認します。問題がなければ、Approve をクリックします。

- Operators → Installed Operators ページに戻り、更新の進捗をモニターします。完了時に、ステータスは Succeeded および Up to date に変更されます。

6.4. 更新ステータスの監視

6.4.1. OpenShift Virtualization アップグレードステータスのモニタリング

OpenShift Virtualization Operator のアップグレードのステータスをモニターするには、クラスターサービスバージョン (CSV) PHASE を監視します。Web コンソールを使用するか、ここに提供されているコマンドを実行して CSV の状態をモニターすることもできます。

PHASE および状態の値は利用可能な情報に基づく近似値になります。

前提条件

-

cluster-adminロールを持つユーザーとしてクラスターにログインすること。 -

OpenShift CLI (

oc) がインストールされている。

手順

以下のコマンドを実行します。

$ oc get csv -n openshift-cnv出力を確認し、

PHASEフィールドをチェックします。以下に例を示します。出力例

VERSION REPLACES PHASE 4.9.0 kubevirt-hyperconverged-operator.v4.8.2 Installing 4.9.0 kubevirt-hyperconverged-operator.v4.9.0 Replacingオプション: 以下のコマンドを実行して、すべての OpenShift Virtualization コンポーネントの状態の集約されたステータスをモニターします。

$ oc get hco -n openshift-cnv kubevirt-hyperconverged \ -o=jsonpath='{range .status.conditions[*]}{.type}{"\t"}{.status}{"\t"}{.message}{"\n"}{end}'アップグレードが成功すると、以下の出力が得られます。

出力例

ReconcileComplete True Reconcile completed successfully Available True Reconcile completed successfully Progressing False Reconcile completed successfully Degraded False Reconcile completed successfully Upgradeable True Reconcile completed successfully

6.4.2. 以前の OpenShift Virtualization ワークロードの表示

CLI を使用して、以前のワークロードのリストを表示できます。

クラスターに以前の仮想化 Pod がある場合には、OutdatedVirtualMachineInstanceWorkloads アラートが実行されます。

手順

以前の仮想マシンインスタンス (VMI) のリストを表示するには、以下のコマンドを実行します。

$ oc get vmi -l kubevirt.io/outdatedLauncherImage --all-namespaces

ワークロードの更新を設定して、VMI が自動的に更新されるようにします。

第7章 セキュリティーポリシー

仮想マシン (VM) のワークロードは、特権のない Pod として実行されます。仮想マシンが OpenShift Virtualization 機能を使用できるように、一部の Pod には、他の Pod 所有者が使用できないカスタムセキュリティーポリシーが付与されます。

-

拡張された

container_tSELinux ポリシーがvirt-launcherPod に適用されます。 -

セキュリティーコンテキスト制約 (SCC) は、

kubevirt-controllerサービスアカウントに対して定義されます。

7.1. ワークロードのセキュリティーについて

デフォルトでは、仮想マシン (VM) のワークロードは OpenShift Virtualization の root 権限では実行されません。

仮想マシンごとに、virt-launcher Pod が libvirt のインスタンスを セッションモード で実行し、仮想マシンプロセスを管理します。セッションモードでは、libvirt デーモンは root 以外のユーザーアカウントとして実行され、同じユーザー識別子 (UID) で実行されているクライアントからの接続のみを許可します。したがって、仮想マシンは権限のない Pod として実行し、最小権限のセキュリティー原則に従います。

root 権限を必要とするサポート対象の OpenShift Virtualization 機能はありません。機能に root が必要な場合は、OpenShift Virtualization での使用がサポートされていない可能性があります。

7.2. virt-launcher Pod の拡張 SELinux ポリシー

virt-launcher Pod の container_t SELinux ポリシーが拡張され、OpenShift 仮想化の重要な機能が有効になります。

ネットワークマルチキューには次のポリシーが必要です。これにより、使用可能な vCPU の数が増加するにつれてネットワークパフォーマンスを拡張できます。

-

allow process self (tun_socket (relabelfrom relabelto attach_queue))

-

次のポリシーによって、

virt-launcherが/proc/cpuinfoおよび/proc/uptimeを含む/procディレクトリーの下のファイルを読み取ることができます。-

allow process proc_type (file (getattr open read))

-

次のポリシーによって、

libvirtdがネットワーク関連のデバッグメッセージをリレーできます。allow process self (netlink_audit_socket (nlmsg_relay))注記このポリシーがない場合、ネットワークデバッグメッセージをリレーしようとする試みはブロックされます。これにより、ノードの監査ログが SELinux 拒否でいっぱいになる可能性があります。

次のポリシーによって、

libvirtdがhugetblfsにアクセスできます。これは、巨大なページをサポートするために必要です。-

allow process hugetlbfs_t (dir (add_name create write remove_name rmdir setattr)) -

allow process hugetlbfs_t (file (create unlink))

-

次のポリシーによって、

virtiofsがファイルシステムをマウントし、NFS にアクセスできます。-

allow process nfs_t (dir (mounton)) -

allow process proc_t (dir (mounton)) -

allow process proc_t (filesystem (mount unmount))

-

SCC (Security Context Constraints) は Pod のパーミッションを制御します。これらのパーミッションには、コンテナーのコレクションである Pod が実行できるアクションおよびそれがアクセスできるリソース情報が含まれます。SCC を使用して、Pod がシステムに受け入れられるために必要な Pod の実行に関する条件の一覧を定義できます。

virt-controller は、クラスター内の仮想マシンの virt-launcher Pod を作成するクラスターコントローラーです。これらの Pod には、kubevirt-controller サービスアカウントによってパーミッションが付与されます。

kubevirt-controller サービスアカウントには追加の SCC および Linux 機能が付与され、これにより適切なパーミッションを持つ virt-launcher Pod を作成できます。これらの拡張パーミッションにより、仮想マシンは通常の Pod の範囲外の OpenShift Virtualization 機能を利用できます。

kubevirt-controller サービスアカウントには以下の SCC が付与されます。

-

scc.AllowHostDirVolumePlugin = true

これは、仮想マシンが hostpath ボリュームプラグインを使用することを可能にします。 -

scc.AllowPrivilegedContainer = false

これは、virt-launcher Pod が権限付きコンテナーとして実行されないようにします。 scc.AllowedCapabilities = []corev1.Capability{"SYS_NICE", "NET_BIND_SERVICE", "SYS_PTRACE"}

-

SYS_NICEを使用すると、CPU アフィニティーを設定できます。 -

NET_BIND_SERVICEは、DHCP および Slirp 操作を許可します。 -

SYS_PTRACEを使用すると、特定バージョンのlibvirtで、ソフトウェア Trusted Platform Module (TPM) エミュレーターであるswtpmのプロセス ID (PID) を見つけることができます。

-

7.3.1. kubevirt-controller の SCC および RBAC 定義の表示

oc ツールを使用して kubevirt-controller の SecurityContextConstraints 定義を表示できます。

$ oc get scc kubevirt-controller -o yaml

oc ツールを使用して kubevirt-controller クラスターロールの RBAC 定義を表示できます。

$ oc get clusterrole kubevirt-controller -o yaml第8章 CLI ツールの使用

クラスターでリソースを管理するために使用される 2 つの主な CLI ツールは以下の通りです。

-

OpenShift virtualization

virtctlクライアント -

OpenShift Container Platform

ocクライアント

8.1. 前提条件

8.2. OpenShift Container Platform クライアントコマンド

OpenShift Container Platform oc クライアントは、VirtualMachine (vm) および VirtualMachineInstance (vmi) オブジェクトタイプを含む、OpenShift Container Platform リソースを管理するためのコマンドラインユーティリティーです。

-n <namespace> フラグを使用して、別のプロジェクトを指定できます。

| コマンド | Description |

|---|---|

|

|

OpenShift Container Platform クラスターに |

|

| 現在のプロジェクトの指定されたオブジェクトタイプのオブジェクトのリストを表示します。 |

|

| 現在のプロジェクトで特定のリソースの詳細を表示します。 |

|

| 現在のプロジェクトで、ファイル名または標準入力 (stdin) からリソースを作成します。 |

|

| 現在のプロジェクトのリソースを編集します。 |

|

| 現在のプロジェクトのリソースを削除します。 |

oc client コマンドについてのより総合的な情報については、OpenShift Container Platform CLI ツール のドキュメントを参照してください。

8.3. Virtctl クライアントコマンド

virtctl クライアントは、OpenShift Virtualization リソースを管理するためのコマンドラインユーティリティーです。

virtctlコマンドのリストを表示するには、次のコマンドを実行します。

$ virtctl help

特定のコマンドで使用できるオプションの一覧を表示するには、これを -h または --help フラグを指定して実行します。以下に例を示します。

$ virtctl image-upload -h

任意のvirtctlコマンドで使用できるグローバルコマンドオプションのリストを表示するには、次のコマンドを実行します。

$ virtctl options

以下の表には、OpenShift Virtualization のドキュメント全体で使用されている virtctl コマンドが記載されています。

| コマンド | Description |

|---|---|

|

| 仮想マシンを起動します。 |

|

| 仮想マシンを一時停止状態で起動します。このオプションを使用すると、VNC コンソールからブートプロセスを中断できます。 |

|

| 仮想マシンを停止します。 |

|

| 仮想マシンを強制停止します。このオプションは、データの不整合またはデータ損失を引き起こす可能性があります。 |

|

| 仮想マシンまたは仮想マシンインスタンスを一時停止します。マシンの状態がメモリーに保持されます。 |

|

| 仮想マシンまたは仮想マシンインスタンスの一時停止を解除します。 |

|

| 仮想マシンを移行します。 |

|

| 仮想マシンを再起動します。 |

|

| 仮想マシンまたは仮想マシンインスタンスの指定されたポートを転送するサービスを作成し、このサービスをノードの指定されたポートで公開します。 |

|

| 仮想マシンインスタンスのシリアルコンソールに接続します。 |

|

| VNC (仮想ネットワーククライアント) の仮想マシンインスタンスへの接続を開きます。ローカルマシンでリモートビューアーを必要とする VNC を使用して仮想マシンインスタンスのグラフィカルコンソールにアクセスします。 |

|

| VNC 接続からビューアーを使用してポート番号を表示し、仮想マシンインスタンスに手動で接続します。 |

|

| ポートが利用可能な場合、その指定されたポートでプロキシーを実行するためにポート番号を指定します。ポート番号が指定されていない場合、プロキシーはランダムポートで実行されます。 |

|

| 仮想マシンイメージをすでに存在するデータボリュームにアップロードします。 |

|

| 仮想マシンイメージを新規データボリューム にアップロードします。 |

|

| クライアントおよびサーバーのバージョン情報を表示します。 |

|

| ゲストマシンで利用可能なファイルシステムの詳細なリストを返します。 |

|

| オペレーティングシステムに関するゲストエージェント情報を返します。 |

|

| ゲストマシンでログインしているユーザーの詳細な一覧を返します。 |

8.4. virtctl guestfs を使用したコンテナーの作成

virtctl guestfs コマンドを使用して、libguestfs-tools および永続ボリューム要求 (PVC) がアタッチされた対話型コンテナーをデプロイできます。

手順

libguestfs-toolsでコンテナーをデプロイして PVC をマウントし、シェルを割り当てるには、以下のコマンドを実行します。$ virtctl guestfs -n <namespace> <pvc_name>1 - 1

- PVC 名は必須の引数です。この引数を追加しないと、エラーメッセージが表示されます。

8.5. Libguestfs ツールおよび virtctl guestfs

Libguestfs ツールは、仮想マシン (VM) のディスクイメージにアクセスして変更するのに役立ちます。libguestfs ツールを使用して、ゲスト内のファイルの表示および編集、仮想マシンのクローンおよびビルド、およびディスクのフォーマットおよびサイズ変更を実行できます。

virtctl guestfs コマンドおよびそのサブコマンドを使用して、PVC で仮想マシンディスクを変更して検査し、デバッグすることもできます。使用可能なサブコマンドの完全なリストを表示するには、コマンドラインで virt- と入力して Tab を押します。以下に例を示します。

| コマンド | 説明 |

|---|---|

|

| ターミナルでファイルを対話的に編集します。 |

|

| ゲストに ssh キーを挿入し、ログインを作成します。 |

|

| 仮想マシンによって使用されるディスク容量を確認します。 |

|

| 詳細のリストを含む出力ファイルを作成して、ゲストにインストールされたすべての RPM の詳細リストを参照してください。 |

|

|

ターミナルで |

|

| テンプレートとして使用する仮想マシンディスクイメージをシールします。 |

デフォルトでは、virtctl guestfs は、仮想ディスク管理に必要な項目を含めてセッションを作成します。ただし、動作をカスタマイズできるように、コマンドは複数のフラグオプションもサポートしています。

| フラグオプション | 説明 |

|---|---|

|

|

|

|

| 特定の namespace から PVC を使用します。

|

|

|

|

|

|

デフォルトでは、

クラスターに

設定されていない場合、 |

|

|

|

このコマンドは、PVC が別の Pod によって使用されているかどうかを確認します。使用されている場合には、エラーメッセージが表示されます。ただし、libguestfs-tools プロセスが開始されると、設定では同じ PVC を使用する新規 Pod を回避できません。同じ PVC にアクセスする仮想マシンを起動する前に、アクティブな virtctl guestfs Pod がないことを確認する必要があります。

virtctl guestfs コマンドは、インタラクティブな Pod に割り当てられている PVC 1 つだけを受け入れます。

第9章 仮想マシン

9.1. 仮想マシンの作成

以下のいずれかの手順を使用して、仮想マシンを作成します。

- クイックスタートのガイド付きツアー

- カタログからクイック作成

- 仮想マシンウィザードによる事前に設定された YAML ファイルの貼り付け

- CLI の使用

openshift-* namespace に仮想マシンを作成しないでください。代わりに、openshift 接頭辞なしの新規 namespace を作成するか、既存 namespace を使用します。

Web コンソールから仮想マシンを作成する場合、ブートソースで設定される仮想マシンテンプレートを選択します。ブートソースを含む仮想マシンテンプレートには Available boot source というラベルが付けられるか、それらはカスタマイズされたラベルテキストを表示します。選択可能なブートソースでテンプレートを使用すると、仮想マシンの作成プロセスをスピードアップできます。

ブートソースのないテンプレートには、Boot source required というラベルが付けられます。仮想マシンにブートソースを追加する 手順を完了すれば、これらのテンプレートを使用することができます。

ストレージの動作の違いにより、一部の仮想マシンテンプレートは単一ノードの Openshift と互換性がありません。互換性を確保するためには、テンプレートまたはデータボリュームまたはストレージプロファイルを使用する仮想マシンにevictionStrategyフィールドを設定しないでください。

9.1.1. クイックスタートの使用による仮想マシンの作成

Web コンソールは、仮想マシンを作成するためのガイド付きツアーを含むクイックスタートを提供します。Administrator パースペクティブの Help メニューを選択して Quick Starts カタログにアクセスし、Quick Starts カタログを表示できます。Quick Starts タイルをクリックし、ツアーを開始すると、システムによるプロセスのガイドが開始します。

Quick Starts のタスクは、Red Hat テンプレートの選択から開始します。次に、ブートソースを追加して、オペレーティングシステムイメージをインポートできます。最後に、カスタムテンプレートを保存し、これを使用して仮想マシンを作成できます。

前提条件

- オペレーティングシステムイメージの URL リンクをダウンロードできる Web サイトにアクセスすること。

手順

- Web コンソールで、Help メニューから Quick Starts を選択します。

- Quick Starts カタログのタイルをクリックします。例: Red Hat Linux Enterprise Linux 仮想マシンの作成

- ガイド付きツアーの手順に従い、オペレーティングシステムイメージのインポートと仮想マシンの作成タスクを実行します。Virtualization → VirtualMachines ページに仮想マシンが表示されます。

9.1.2. 仮想マシンのクイック作成

使用可能なブートソースを含むテンプレートを使用して、仮想マシン (VM) をすばやく作成できます。

手順

- サイドメニューの Virtualization → Catalog をクリックします。

利用可能なブートソース をクリックして、テンプレートをブートソースでフィルタリングします。

注記デフォルトでは、テンプレートリストには Default Templates のみが表示されます。選択したフィルターで使用可能なすべてのテンプレートを表示するには、フィルタリング時に すべてのアイテムをクリックします。

- テンプレートをクリックして詳細を表示します。

仮想マシンのクイック作成をクリックして、テンプレートから VM を作成します。

仮想マシンの詳細ページに、プロビジョニングステータスが表示されます。

検証

- Events をクリックして、仮想マシンがプロビジョニングされたときにイベントのストリームを表示します。

- Console をクリックして、仮想マシンが正常に起動したことを確認します。

9.1.3. カスタマイズされたテンプレートからの仮想マシンの作成

一部のテンプレートでは、追加のパラメーターが必要です。たとえば、ブート ソースを持つ PVC などです。テンプレートの選択パラメーターをカスタマイズして、仮想マシン (VM) を作成できます。

手順

Web コンソールで、テンプレートを選択します。

- サイドメニューの Virtualization → Catalog をクリックします。

- オプション: プロジェクト、キーワード、オペレーティングシステム、またはワークロードプロファイルでテンプレートをフィルター処理します。

- カスタマイズするテンプレートをクリックします。

- Customize VirtualMachineを クリックします。

- Name や Disk source など、仮想マシンのパラメーターを指定します。オプションで、複製するデータソースを指定できます。

検証

- Events をクリックして、仮想マシンがプロビジョニングされたときにイベントのストリームを表示します。

- Console をクリックして、仮想マシンが正常に起動したことを確認します。

Web コンソールから仮想マシンを作成する場合は、仮想マシンのフィールドセクションを参照してください。

9.1.3.1. 仮想マシンフィールド

以下の表には、OpenShift Container Platform Web コンソールで編集できる仮想マシンのフィールドが記載されています。

| タブ | フィールドまたは機能 |

|---|---|

| 概要 |

|

| YAML |

|

| スケジューリング |

|

| 環境 |

|

| Network Interfaces |

|

| ディスク |

|

| スクリプト |

|

| メタデータ |

|

9.1.3.1.1. ネットワークフィールド

| Name | 説明 |

|---|---|

| Name | ネットワークインターフェイスコントローラーの名前。 |

| モデル | ネットワークインターフェイスコントローラーのモデルを示します。サポートされる値は e1000e および virtio です。 |

| Network | 利用可能なネットワーク接続定義のリスト。 |

| タイプ | 利用可能なバインディングメソッドの一覧。ネットワークインターフェイスに適したバインド方法を選択します。

|

| MAC Address | ネットワークインターフェイスコントローラーの MAC アドレス。MAC アドレスが指定されていない場合、これは自動的に割り当てられます。 |

9.1.3.2. ストレージフィールド

| Name | 選択 | Description |

|---|---|---|

| Source | 空白 (PVC の作成) | 空のディスクを作成します。 |

| URL を使用したインポート (PVC の作成) | URL (HTTP または HTTPS エンドポイント) を介してコンテンツをインポートします。 | |

| 既存 PVC の使用 | クラスターですでに利用可能な PVC を使用します。 | |

| 既存の PVC のクローン作成 (PVC の作成) | クラスターで利用可能な既存の PVC を選択し、このクローンを作成します。 | |

| レジストリーを使用したインポート (PVC の作成) | コンテナーレジストリーを使用してコンテンツをインポートします。 | |

| コンテナー (一時的) | クラスターからアクセスできるレジストリーにあるコンテナーからコンテンツをアップロードします。コンテナーディスクは、CD-ROM や一時的な仮想マシンなどの読み取り専用ファイルシステムにのみ使用する必要があります。 | |

| Name |

ディスクの名前。この名前には、小文字 ( | |

| Size | ディスクのサイズ (GiB 単位)。 | |

| タイプ | ディスクのタイプ。例: Disk または CD-ROM | |

| Interface | ディスクデバイスのタイプ。サポートされるインターフェイスは、virtIO、SATA、および SCSI です。 | |

| Storage Class | ディスクの作成に使用されるストレージクラス。 |

ストレージの詳細設定

以下のストレージの詳細設定はオプションであり、Blank、Import via URLURL、および Clone existing PVC ディスクで利用できます。OpenShift Virtualization 4.11 より前では、これらのパラメーターを指定しない場合、システムは kubevirt-storage-class-defaults 設定マップのデフォルト値を使用します。OpenShift Virtualization 4.11 以降では、システムは ストレージプロファイル のデフォルト値を使用します。

ストレージプロファイルを使用して、OpenShift Virtualization のストレージをプロビジョニングするときに一貫した高度なストレージ設定を確保します。

Volume Mode と Access Mode を手動で指定するには、デフォルトで選択されている Apply optimized StorageProfile settings チェックボックスをオフにする必要があります。

| Name | モードの説明 | パラメーター | パラメーターの説明 |

|---|---|---|---|

| ボリュームモード | 永続ボリュームがフォーマットされたファイルシステムまたは raw ブロック状態を使用するかどうかを定義します。デフォルトは Filesystem です。 | Filesystem | ファイルシステムベースのボリュームで仮想ディスクを保存します。 |

| Block |

ブロックボリュームで仮想ディスクを直接保存します。基礎となるストレージがサポートしている場合は、 | ||

| アクセスモード | 永続ボリュームのアクセスモード。 | ReadWriteOnce (RWO) | ボリュームは単一ノードで読み取り/書き込みとしてマウントできます。 |

| ReadWriteMany (RWX) | ボリュームは、一度に多くのノードで読み取り/書き込みとしてマウントできます。 注記 これは、ノード間の仮想マシンのライブマイグレーションなどの、一部の機能で必要になります。 | ||

| ReadOnlyMany (ROX) | ボリュームは数多くのノードで読み取り専用としてマウントできます。 |

9.1.3.3. Cloud-init フィールド

| Name | 説明 |

|---|---|

| Hostname | 仮想マシンの特定のホスト名を設定します。 |

| 認可された SSH キー | 仮想マシンの ~/.ssh/authorized_keys にコピーされるユーザーの公開鍵。 |

| カスタムスクリプト | 他のオプションを、カスタム cloud-init スクリプトを貼り付けるフィールドに置き換えます。 |

ストレージクラスのデフォルトを設定するには、ストレージプロファイルを使用します。詳細については、ストレージプロファイルのカスタマイズを参照してください。

9.1.3.4. 仮想マシンウィザードの作成用の事前に設定された YAML ファイルの貼り付け

YAML 設定ファイルを作成し、解析して仮想マシンを作成します。YAML 編集画面を開くと、常に有効な example 仮想マシン設定がデフォルトで提供されます。

Create をクリックする際に YAML 設定が無効な場合、エラーメッセージでエラーが発生したパラメーターが示唆されます。エラーは一度に 1 つのみ表示されます。

編集中に YAML 画面から離れると、設定に対して加えた変更が取り消されます。

手順

- サイドメニューから Virtualization → VirtualMachines をクリックします。

- Create をクリックし、With YAML を選択します。

編集可能なウィンドウで仮想マシンの設定を作成するか、これを貼り付けます。

-

または、YAML 画面にデフォルトで提供される

example仮想マシンを使用します。

-

または、YAML 画面にデフォルトで提供される

- オプション: Download をクリックして YAML 設定ファイルをその現在の状態でダウンロードします。

- Create をクリックして仮想マシンを作成します。

仮想マシンが VirtualMachines ページにリスト表示されます。

9.1.4. CLI の使用による仮想マシンの作成

virtualMachine マニフェストから仮想マシンを作成できます。

手順

仮想マシンの

VirtualMachineマニフェストを編集します。たとえば、次のマニフェストは Red Hat Enterprise Linux (RHEL) 仮想マシンを設定します。例9.1 RHEL 仮想マシンのマニフェストの例

apiVersion: kubevirt.io/v1 kind: VirtualMachine metadata: labels: app: <vm_name>1 name: <vm_name> spec: dataVolumeTemplates: - apiVersion: cdi.kubevirt.io/v1beta1 kind: DataVolume metadata: name: <vm_name> spec: sourceRef: kind: DataSource name: rhel9 namespace: openshift-virtualization-os-images storage: resources: requests: storage: 30Gi running: false template: metadata: labels: kubevirt.io/domain: <vm_name> spec: domain: cpu: cores: 1 sockets: 2 threads: 1 devices: disks: - disk: bus: virtio name: rootdisk - disk: bus: virtio name: cloudinitdisk interfaces: - masquerade: {} name: default rng: {} features: smm: enabled: true firmware: bootloader: efi: {} resources: requests: memory: 8Gi evictionStrategy: LiveMigrate networks: - name: default pod: {} volumes: - dataVolume: name: <vm_name> name: rootdisk - cloudInitNoCloud: userData: |- #cloud-config user: cloud-user password: '<password>'2 chpasswd: { expire: False } name: cloudinitdiskマニフェストファイルを使用して仮想マシンを作成します。

$ oc create -f <vm_manifest_file>.yamlオプション: 仮想マシンを開始します。

$ virtctl start <vm_name>

9.1.5. 仮想マシンのストレージボリュームタイプ

| ストレージボリュームタイプ | Description |

|---|---|

| ephemeral | ネットワークボリュームを読み取り専用のバッキングストアとして使用するローカルの copy-on-write (COW) イメージ。バッキングボリュームは PersistentVolumeClaim である必要があります。一時イメージは仮想マシンの起動時に作成され、すべての書き込みをローカルに保存します。一時イメージは、仮想マシンの停止、再起動または削除時に破棄されます。バッキングボリューム (PVC) はいずれの方法でも変更されません。 |

| persistentVolumeClaim | 利用可能な PV を仮想マシンに割り当てます。PV の割り当てにより、仮想マシンデータのセッション間での永続化が可能になります。 CDI を使用して既存の仮想マシンディスクを PVC にインポートし、PVC を仮想マシンインスタンスに割り当てる方法は、既存の仮想マシンを OpenShift Container Platform にインポートするための推奨される方法です。ディスクを PVC 内で使用できるようにするためのいくつかの要件があります。 |

| dataVolume |

データボリュームは、インポート、クローンまたはアップロード操作で仮想マシンディスクの準備プロセスを管理することによって

|

| cloudInitNoCloud | 参照される cloud-init NoCloud データソースが含まれるディスクを割り当て、ユーザーデータおよびメタデータを仮想マシンに提供します。cloud-init インストールは仮想マシンディスク内で必要になります。 |

| containerDisk | コンテナーイメージレジストリーに保存される、仮想マシンディスクなどのイメージを参照します。イメージはレジストリーからプルされ、仮想マシンの起動時にディスクとして仮想マシンに割り当てられます。

RAW および QCOW2 形式のみがコンテナーイメージレジストリーのサポートされるディスクタイプです。QCOW2 は、縮小されたイメージサイズの場合に推奨されます。 注記

|

| emptyDisk | 仮想マシンインターフェイスのライフサイクルに関連付けられるスパースの QCOW2 ディスクを追加で作成します。データは仮想マシンのゲストによって実行される再起動後も存続しますが、仮想マシンが Web コンソールから停止または再起動する場合には破棄されます。空のディスクは、アプリケーションの依存関係および一時ディスクの一時ファイルシステムの制限を上回るデータを保存するために使用されます。 ディスク 容量 サイズも指定する必要があります。 |

9.1.6. 仮想マシンの RunStrategy について

仮想マシンの RunStrategy は、一連の条件に応じて仮想マシンインスタンス (VMI) の動作を判別します。spec.runStrategy 設定は、spec.running 設定の代わりに仮想マシン設定プロセスに存在します。spec.runStrategy 設定を使用すると、true または false の応答のみを伴う spec.running 設定とは対照的に、VMI の作成および管理をより柔軟に行えます。ただし、2 つの設定は相互排他的です。spec.running または spec.runStrategy のいずれかを使用できます。両方を使用する場合は、エラーが発生します。

4 つ RunStrategy が定義されています。

Always-

VMI は仮想マシンの作成時に常に表示されます。元の VMI が何らかの理由で停止する場合に、新規の VMI が作成されます。これは

spec.running: trueと同じ動作です。 RerunOnFailure- 前のインスタンスがエラーが原因で失敗する場合は、VMI が再作成されます。インスタンスは、仮想マシンが正常に停止する場合 (シャットダウン時など) には再作成されません。

Manual(手動)-

start、stop、およびrestartvirtctl クライアントコマンドは、 VMI の状態および存在を制御するために使用できます。 Halted-

仮想マシンが作成される際に VMI は存在しません。これは

spec.running: falseと同じ動作です。

start、stop、および restart の virtctl コマンドの各種の組み合わせは、どの RunStrategy が使用されるかに影響を与えます。

以下の表は、仮想マシンの各種の状態からの移行について示しています。最初の列には、仮想マシンの初期の RunStrategy が表示されます。それぞれの追加の列には、virtctl コマンドと、このコマンド実行後の新規 RunStrategy が表示されます。

| 初期 RunStrategy | start | stop | restart |

|---|---|---|---|

| Always | - | Halted | Always |

| RerunOnFailure | - | Halted | RerunOnFailure |

| Manual | Manual | Manual | Manual |

| Halted | Always | - | - |

インストーラーでプロビジョニングされるインフラストラクチャーを使用してインストールされた OpenShift Virtualization クラスターでは、ノードで MachineHealthCheck に失敗し、クラスターで利用できなくなると、RunStrategy が Always または RerunOnFailure の仮想マシンが新規ノードで再スケジュールされます。

apiVersion: kubevirt.io/v1

kind: VirtualMachine

spec:

RunStrategy: Always

template:

...- 1

- VMI の現在の

RunStrategy設定。

9.2. 仮想マシンの編集

Web コンソールの YAML エディターまたはコマンドラインの OpenShift CLI のいずれかを使用して、仮想マシン設定を更新できます。Virtual Machine Details 画面でパラメーターのサブセットを更新することもできます。

9.2.1. Web コンソールでの仮想マシンの編集

関連するフィールドの横にある鉛筆アイコンをクリックして、Web コンソールで仮想マシンの選択する値 (select values) を編集します。他の値は、CLI を使用して編集できます。

Red Hat が提供するものを含め、任意のテンプレートのラベルとアノテーションを編集できます。その他のフィールドは、ユーザーがカスタマイズしたテンプレートでのみ編集できます。

手順

- サイドメニューから Virtualization → VirtualMachines をクリックします。

- オプション: Filter ドロップダウン メニューを使用して、ステータス、テンプレート、ノード、またはオペレーティング システム (OS) などの属性で仮想マシンのリストを並べ替えます。

- 仮想マシンを選択して、VirtualMachine details ページを開きます。

- フィールドが編集可能であることを示す鉛筆アイコンが付いているフィールドをクリックします。たとえば、BIOS や UEFI などの現在の ブートモード 設定をクリックして、Boot mode ウィンドウを開き、リストからオプションを選択します。

- 関連する変更を加え、Save をクリックします。

仮想マシンが実行されている場合、Boot Order または Flavor への変更は仮想マシンを再起動するまで反映されません。

関連するフィールドの右側にある View Pending Changes をクリックして、保留中の変更を表示できます。ページ上部の Pending Changes バナーには、仮想マシンの再起動時に適用されるすべての変更の一覧が表示されます。

9.2.1.1. 仮想マシンフィールド

以下の表には、OpenShift Container Platform Web コンソールで編集できる仮想マシンのフィールドが記載されています。

| タブ | フィールドまたは機能 |

|---|---|

| Details |

|

| YAML |

|

| スケジューリング |

|

| Network Interfaces |

|

| ディスク |

|

| スクリプト |

|

| スナップショット |

|

9.2.2. Web コンソールを使用した仮想マシンの YAML 設定の編集

Web コンソールで、仮想マシンの YAML 設定を編集できます。一部のパラメーターは変更できません。無効な設定で Save をクリックすると、エラーメッセージで変更できないパラメーターが示唆されます。

編集中に YAML 画面から離れると、設定に対して加えた変更が取り消されます。

手順

- サイドメニューから Virtualization → VirtualMachines をクリックします。

- 仮想マシンを選択します。

- YAML タブをクリックして編集可能な設定を表示します。

- オプション: Download をクリックして YAML ファイルをその現在の状態でローカルにダウンロードできます。

- ファイルを編集し、Save をクリックします。

オブジェクトの更新されたバージョン番号を含む、変更が正常に行われたことを示す確認メッセージが表示されます。

9.2.3. CLI を使用した仮想マシン YAML 設定の編集

以下の手順を使用し、CLI を使用して仮想マシン YAML 設定を編集します。

前提条件

- YAML オブジェクト設定ファイルを使用して仮想マシンを設定していること。

-

ocCLI をインストールしていること。

手順

以下のコマンドを実行して、仮想マシン設定を更新します。

$ oc edit <object_type> <object_ID>- オブジェクト設定を開きます。

- YAML を編集します。

実行中の仮想マシンを編集する場合は、以下のいずれかを実行する必要があります。

- 仮想マシンを再起動します。

新規の設定を有効にするために、以下のコマンドを実行します。

$ oc apply <object_type> <object_ID>

9.2.4. 仮想マシンへの仮想ディスクの追加

以下の手順を使用して仮想ディスクを仮想マシンに追加します。

手順

- サイドメニューから Virtualization → VirtualMachines をクリックします。

- 仮想マシンを選択して、VirtualMachine details 画面を開きます。

- Disks タブをクリックし、Add disk をクリックします。

Add disk ウィンドウで、Source、Name、Size、Type、Interface、および Storage Class を指定します。

- オプション: 空のディスクソースを使用し、データボリュームの作成時に最大の書き込みパフォーマンスが必要な場合に、事前割り当てを有効にできます。そのためには、Enable preallocation チェックボックスをオンにします。

-

オプション: Apply optimized StorageProfile settings をクリアして、仮想ディスクの Volume Mode と Access Mode を変更できます。これらのパラメーターを指定しない場合、システムは

kubevirt-storage-class-defaultsconfig map のデフォルト値を使用します。

- Add をクリックします。

仮想マシンが実行中の場合、新規ディスクは pending restart 状態にあり、仮想マシンを再起動するまで割り当てられません。

ページ上部の Pending Changes バナーには、仮想マシンの再起動時に適用されるすべての変更の一覧が表示されます。

ストレージクラスのデフォルトを設定するには、ストレージプロファイルを使用します。詳細については、ストレージプロファイルのカスタマイズを参照してください。

9.2.4.1. VirtualMachine の CD-ROM の編集

以下の手順を使用して、仮想マシンの CD-ROM を編集します。

手順

- サイドメニューから Virtualization → VirtualMachines をクリックします。

- 仮想マシンを選択して、VirtualMachine details 画面を開きます。

- Disks タブをクリックします。

-

編集する CD-ROM の Options メニュー

をクリックし、Edit を選択します。

をクリックし、Edit を選択します。

- Edit CD-ROM ウィンドウで、Source、Persistent Volume Claim、Name、Type、および Interface フィールドを編集します。

- Save をクリックします。

9.2.4.2. ストレージフィールド

| Name | 選択 | Description |

|---|---|---|

| Source | 空白 (PVC の作成) | 空のディスクを作成します。 |

| URL を使用したインポート (PVC の作成) | URL (HTTP または HTTPS エンドポイント) を介してコンテンツをインポートします。 | |

| 既存 PVC の使用 | クラスターですでに利用可能な PVC を使用します。 | |

| 既存の PVC のクローン作成 (PVC の作成) | クラスターで利用可能な既存の PVC を選択し、このクローンを作成します。 | |

| レジストリーを使用したインポート (PVC の作成) | コンテナーレジストリーを使用してコンテンツをインポートします。 | |

| コンテナー (一時的) | クラスターからアクセスできるレジストリーにあるコンテナーからコンテンツをアップロードします。コンテナーディスクは、CD-ROM や一時的な仮想マシンなどの読み取り専用ファイルシステムにのみ使用する必要があります。 | |

| Name |

ディスクの名前。この名前には、小文字 ( | |

| Size | ディスクのサイズ (GiB 単位)。 | |

| タイプ | ディスクのタイプ。例: Disk または CD-ROM | |

| Interface | ディスクデバイスのタイプ。サポートされるインターフェイスは、virtIO、SATA、および SCSI です。 | |

| Storage Class | ディスクの作成に使用されるストレージクラス。 |

ストレージの詳細設定

以下のストレージの詳細設定はオプションであり、Blank、Import via URLURL、および Clone existing PVC ディスクで利用できます。OpenShift Virtualization 4.11 より前では、これらのパラメーターを指定しない場合、システムは kubevirt-storage-class-defaults 設定マップのデフォルト値を使用します。OpenShift Virtualization 4.11 以降では、システムは ストレージプロファイル のデフォルト値を使用します。

ストレージプロファイルを使用して、OpenShift Virtualization のストレージをプロビジョニングするときに一貫した高度なストレージ設定を確保します。

Volume Mode と Access Mode を手動で指定するには、デフォルトで選択されている Apply optimized StorageProfile settings チェックボックスをオフにする必要があります。

| Name | モードの説明 | パラメーター | パラメーターの説明 |

|---|---|---|---|

| ボリュームモード | 永続ボリュームがフォーマットされたファイルシステムまたは raw ブロック状態を使用するかどうかを定義します。デフォルトは Filesystem です。 | Filesystem | ファイルシステムベースのボリュームで仮想ディスクを保存します。 |

| Block |

ブロックボリュームで仮想ディスクを直接保存します。基礎となるストレージがサポートしている場合は、 | ||

| アクセスモード | 永続ボリュームのアクセスモード。 | ReadWriteOnce (RWO) | ボリュームは単一ノードで読み取り/書き込みとしてマウントできます。 |

| ReadWriteMany (RWX) | ボリュームは、一度に多くのノードで読み取り/書き込みとしてマウントできます。 注記 これは、ノード間の仮想マシンのライブマイグレーションなどの、一部の機能で必要になります。 | ||

| ReadOnlyMany (ROX) | ボリュームは数多くのノードで読み取り専用としてマウントできます。 |

9.2.5. 仮想マシンへのネットワークインターフェイスの追加

以下の手順を使用してネットワークインターフェイスを仮想マシンに追加します。

手順

- サイドメニューから Virtualization → VirtualMachines をクリックします。

- 仮想マシンを選択して、VirtualMachine details 画面を開きます。

- Network Interfaces タブをクリックします。

- Add Network Interface をクリックします。

- Add Network Interface ウィンドウで、ネットワークインターフェイスの Name、Model、Network、 Type、および MAC Address を指定します。

- Add をクリックします。

仮想マシンが実行中の場合、新規ネットワークインターフェイスは pending restart 状態にあり、仮想マシンを再起動するまで変更は反映されません。

ページ上部の Pending Changes バナーには、仮想マシンの再起動時に適用されるすべての変更のリストが表示されます。

9.2.5.1. ネットワークフィールド

| Name | 説明 |

|---|---|

| Name | ネットワークインターフェイスコントローラーの名前。 |

| モデル | ネットワークインターフェイスコントローラーのモデルを示します。サポートされる値は e1000e および virtio です。 |

| Network | 利用可能なネットワーク接続定義のリスト。 |

| タイプ | 利用可能なバインディングメソッドの一覧。ネットワークインターフェイスに適したバインド方法を選択します。

|

| MAC Address | ネットワークインターフェイスコントローラーの MAC アドレス。MAC アドレスが指定されていない場合、これは自動的に割り当てられます。 |

9.3. ブート順序の編集

Web コンソールまたは CLI を使用して、ブート順序リストの値を更新できます。

Virtual Machine Overview ページの Boot Order で、以下を実行できます。

- ディスクまたはネットワークインターフェイスコントローラー (NIC) を選択し、これをブート順序のリストに追加します。

- ブート順序の一覧でディスクまたは NIC の順序を編集します。

- ブート順序のリストからディスクまたは NIC を削除して、起動可能なソースのインベントリーに戻します。

9.3.1. Web コンソールでのブート順序リストへの項目の追加

Web コンソールを使用して、ブート順序リストに項目を追加します。

手順

- サイドメニューから Virtualization → VirtualMachines をクリックします。

- 仮想マシンを選択して、VirtualMachine details ページを開きます。

- Details タブをクリックします。