Virtualization

OpenShift Virtualization のインストール、使用方法、およびリリースノート

概要

第1章 概要

1.1. OpenShift Virtualization について

OpenShift Virtualization の機能およびサポート範囲を確認します。

1.1.1. OpenShift Virtualization の機能

OpenShift Virtualization は OpenShift Container Platform のアドオンであり、仮想マシンのワークロードを実行し、このワークロードをコンテナーのワークロードと共に管理することを可能にします。

OpenShift Virtualization は、Kubernetes カスタムリソースにより新規オブジェクトを OpenShift Container Platform クラスターに追加し、仮想化タスクを有効にします。これらのタスクには、以下が含まれます。

- Linux および Windows 仮想マシン (VM) の作成と管理

- クラスター内で Pod と仮想マシンのワークロードの同時実行

- 各種コンソールおよび CLI ツールの使用による仮想マシンへの接続

- 既存の仮想マシンのインポートおよびクローン作成

- ネットワークインターフェイスコントローラーおよび仮想マシンに割り当てられたストレージディスクの管理

- 仮想マシンのノード間でのライブマイグレーション

機能強化された Web コンソールは、これらの仮想化されたリソースを OpenShift Container Platform クラスターコンテナーおよびインフラストラクチャーと共に管理するためのグラフィカルポータルを提供します。

OpenShift Virtualization は、Red Hat OpenShift Data Foundation の機能とうまく連携するように設計およびテストされています。

OpenShift Data Foundation を使用して OpenShift Virtualization をデプロイする場合は、Windows 仮想マシンディスク用の専用ストレージクラスを作成する必要があります。詳細は Optimizing ODF PersistentVolumes for Windows VMs を参照してください。

OpenShift Virtualization は 、OVN-Kubernetes、OpenShift SDN、または 認定 OpenShift CNI プラグイン にリストされている他の認定ネットワークプラグインのいずれかとともに使用できます。

Compliance Operator をインストールし、ocp4-moderate および ocp4-moderate-nodeプロファイル を使用してスキャンを実行することで、OpenShift Virtualization クラスターのコンプライアンス問題を確認できます。Compliance Operator は、NIST 認定ツール である OpenSCAP を使用して、セキュリティーポリシーをスキャンし、適用します。

特殊なストレージ、ネットワーク、バックアップ、および追加機能に関して、独立系ソフトウェアベンダー (ISV) およびサービスパートナーと連携する方法は、Red Hat Ecosystem Catalog を参照してください。

1.1.1.1. OpenShift Virtualization サポートのクラスターバージョン

OpenShift Virtualization 4.15 の最新の安定リリースは 4.15.10 です。

OpenShift Virtualization 4.15 は、OpenShift Container Platform 4.15 クラスターでの使用がサポートされます。OpenShift Virtualization の最新の z-stream リリースを使用するには、最初に OpenShift Container Platform の最新バージョンにアップグレードする必要があります。

1.1.2. 仮想マシンディスクのボリュームとアクセスモードについて

既知のストレージプロバイダーでストレージ API を使用する場合、ボリュームモードとアクセスモードは自動的に選択されます。ただし、ストレージプロファイルのないストレージクラスを使用する場合は、ボリュームとアクセスモードを設定する必要があります。

OpenShift Virtualization に対応している既知のストレージプロバイダーのリストは、Red Hat Ecosystem Catalog を参照してください。

最良の結果を得るには、ReadWriteMany (RWX) アクセスモードと Block ボリュームモードを使用してください。これは、以下の理由により重要です。

-

ライブマイグレーションには

ReadWriteMany(RWX) アクセスモードが必要です。 Blockボリュームモードは、Filesystemボリュームモードよりもパフォーマンスが大幅に優れています。これは、Filesystemボリュームモードでは、ファイルシステムレイヤーやディスクイメージファイルなどを含め、より多くのストレージレイヤーが使用されるためです。仮想マシンのディスクストレージに、これらのレイヤーは必要ありません。たとえば、Red Hat OpenShift Data Foundation を使用する場合は、CephFS ボリュームよりも Ceph RBD ボリュームの方が推奨されます。

次の設定の仮想マシンをライブマイグレーションすることはできません。

-

ReadWriteOnce(RWO) アクセスモードのストレージボリューム - GPU などのパススルー機能

これらの仮想マシンの evictionStrategy フィールドを None に設定します。None ストラテジーでは、ノードの再起動中に仮想マシンの電源がオフになります。

1.1.3. シングルノード OpenShift の違い

OpenShift Virtualization はシングルノード OpenShift にインストールできます。

ただし、シングルノード OpenShift は次の機能をサポートしていないことに注意してください。

- 高可用性

- Pod の中断

- ライブマイグレーション

- エビクションストラテジーが設定されている仮想マシンまたはテンプレート

1.2. 適用される制限

OpenShift Virtualization 用の OpenShift Container Platform 環境を計画するときには、オブジェクトのテスト済み最大値を参考にしてください。ただし、最大値に近いと、パフォーマンスが低下し、レイテンシーが増加する可能性があります。必ず具体的なユースケースを計画し、クラスターのスケーリングに影響を与える可能性のあるすべての要素を考慮してください。

クラスター設定とパフォーマンスに影響するオプションの詳細は、Red Hat ナレッジベースの OpenShift Virtualization - Tuning & Scaling Guide を参照してください。

1.2.1. OpenShift Virtualization のテスト済み最大値

大規模な OpenShift Virtualization 4.x 環境には、次の制限が適用されます。これらの制限は、作成可能な最大サイズの単一クラスターに基づくものです。環境を計画するときは、複数の小規模なクラスターがユースケースに最適な選択肢になる可能性があることに留意してください。

1.2.1.1. 仮想マシンの最大値

OpenShift Virtualization 上で実行される仮想マシン (VM) には、次の最大値が適用されます。これらの値は、Virtualization limits for Red Hat Enterprise Linux with KVM に記載されている制限に準じます。

| 対象 (仮想マシンあたり) | テスト済みの制限 | 理論上の制限 |

|---|---|---|

| 仮想 CPU | 216 個の仮想 CPU | 255 個の仮想 CPU |

| メモリー | 6 TB | 16 TB |

| 1 つのディスクのサイズ | 20 TB | 100 TB |

| ホットプラグ可能なディスク | 255 個のディスク | 該当なし |

各仮想マシンには少なくとも 512 MB のメモリーが必要です。

1.2.1.2. ホストの最大値

OpenShift Virtualization に使用される OpenShift Container Platform ホストには、次の最大値が適用されます。

| 対象 (ホストあたり) | テスト済みの制限 | 理論上の制限 |

|---|---|---|

| 論理 CPU コアまたはスレッド | Red Hat Enterprise Linux (RHEL) と同じ | N/A |

| RAM | RHEL と同じ | 該当なし |

| 同時ライブマイグレーション | デフォルトでは、ノードあたり 2 つのアウトバウンドマイグレーション、クラスターあたり 5 つの同時マイグレーション | NIC 帯域幅に依存 |

| ライブマイグレーション帯域幅 | デフォルトの制限なし | NIC 帯域幅に依存 |

1.2.1.3. クラスターの最大値

OpenShift Virtualization で定義されたオブジェクトには、次の最大値が適用されます。

| 対象 (クラスターあたり) | テスト済みの制限 | 理論上の制限 |

|---|---|---|

| ノードあたりの接続 PV 数 | 該当なし | CSI ストレージプロバイダーに依存 |

| PV 最大サイズ | 該当なし | CSI ストレージプロバイダーに依存 |

| ホスト | 500 台のホスト (100 以下を推奨) [1] | OpenShift Container Platform と同じ |

| 定義された仮想マシン | 10,000 台の仮想マシン [2] | OpenShift Container Platform と同じ |

100 を超えるノードを使用する場合は、単一のコントロールプレーンをスケールアウトするのではなく、Red Hat Advanced Cluster Management (RHACM) を使用して複数のクラスターを管理することを検討してください。クラスターが大きくなると複雑さが増し、更新に長い時間が必要になります。また、ノードのサイズとオブジェクトの合計密度によっては、コントロールプレーンのストレスが増加する可能性があります。

複数のクラスターを使用すると、クラスターごとの分離や高可用性などの面でメリットが得られます。

ノードあたりの仮想マシンの最大数は、ホストのハードウェアとリソース容量によって異なります。また、次のパラメーターによって制限されます。

-

ノードにスケジュールできる Pod の数を制限する設定。たとえば、

maxPodsなどです。 -

KVM デバイスのデフォルトの数。たとえば、

devices.kubevirt.io/kvm: 1kなどです。

-

ノードにスケジュールできる Pod の数を制限する設定。たとえば、

1.3. セキュリティーポリシー

OpenShift Virtualization のセキュリティーと認可を説明します。

主なポイント

-

OpenShift Virtualization は、Pod セキュリティーの現在のベストプラクティスを強制することを目的とした、

restrictedKubernetes pod security standards プロファイルに準拠しています。 - 仮想マシン (VM) のワークロードは、特権のない Pod として実行されます。

-

Security Context Constraints (SCC) は

、kubevirt-controllerサービスアカウントに対して定義されています。 - OpenShift Virtualization コンポーネントの TLS 証明書は更新され、自動的にローテーションされます。

1.3.1. ワークロードのセキュリティーについて

デフォルトでは、OpenShift Virtualization の仮想マシン (VM) ワークロードは root 権限では実行されず、root 権限を必要とするサポート対象の OpenShift Virtualization 機能はありません。

仮想マシンごとに、virt-launcher Pod が libvirt のインスタンスを セッションモード で実行し、仮想マシンプロセスを管理します。セッションモードでは、libvirt デーモンは root 以外のユーザーアカウントとして実行され、同じユーザー識別子 (UID) で実行されているクライアントからの接続のみを許可します。したがって、仮想マシンは権限のない Pod として実行し、最小権限のセキュリティー原則に従います。

1.3.2. TLS 証明書

OpenShift Virtualization コンポーネントの TLS 証明書は更新され、自動的にローテーションされます。手動で更新する必要はありません。

自動更新スケジュール

TLS 証明書は自動的に削除され、以下のスケジュールに従って置き換えられます。

- KubeVirt 証明書は毎日更新されます。

- Containerized Data Importer controller (CDI) 証明書は、15 日ごとに更新されます。

- MAC プール証明書は毎年更新されます。

TLS 証明書の自動ローテーションはいずれの操作も中断しません。たとえば、以下の操作は中断せずに引き続き機能します。

- 移行

- イメージのアップロード

- VNC およびコンソールの接続

1.3.3. 認可

OpenShift Virtualization は 、ロールベースのアクセス制御 (RBAC) を使用して、人間のユーザーとサービスアカウントの権限を定義します。サービスアカウントに定義された権限は、OpenShift Virtualization コンポーネントが実行できるアクションを制御します。

RBAC ロールを使用して、仮想化機能へのユーザーアクセスを管理することもできます。たとえば管理者は、仮想マシンの起動に必要な権限を提供する RBAC ロールを作成できます。管理者は、ロールを特定のユーザーにバインドすることでアクセスを制限できます。

1.3.3.1. OpenShift Virtualization のデフォルトのクラスターロール

クラスターロール集約を使用することで、OpenShift Virtualization はデフォルトの OpenShift Container Platform クラスターロールを拡張して、仮想化オブジェクトにアクセスするための権限を組み込みます。

| デフォルトのクラスターロール | OpenShift Virtualization のクラスターロール | OpenShift Virtualization クラスターロールの説明 |

|---|---|---|

|

|

| クラスター内の OpenShift Virtualization リソースをすべて表示できるユーザー。ただし、リソースの作成、削除、変更、アクセスはできません。たとえば、ユーザーは仮想マシン (VM) が実行中であることを確認できますが、それをシャットダウンしたり、そのコンソールにアクセスしたりすることはできません。 |

|

|

| クラスター内のすべての OpenShift Virtualization リソースを変更できるユーザー。たとえば、ユーザーは仮想マシンの作成、VM コンソールへのアクセス、仮想マシンの削除を行えます。 |

|

|

|

リソースコレクションの削除を含め、すべての OpenShift Virtualization リソースに対する完全な権限を持つユーザー。このユーザーは、 |

1.3.3.2. OpenShift Virtualization のストレージ機能の RBAC ロール

cdi-operator および cdi-controller サービスアカウントを含む、次のパーミッションがコンテナー化データインポーター (CDI) に付与されます。

1.3.3.2.1. クラスター全体の RBAC のロール

| CDI クラスターのロール | リソース | 動詞 |

|---|---|---|

|

|

|

|

|

|

| |

|

|

|

|

|

|

| |

|

|

|

|

|

|

| |

|

|

|

|

| API グループ | リソース | 動詞 |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

許可リスト: |

|

|

|

許可リスト: |

|

|

|

|

|

| API グループ | リソース | 動詞 |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1.3.3.2.2. namespace 付きの RBAC ロール

| API グループ | リソース | 動詞 |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| API グループ | リソース | 動詞 |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1.3.3.3. kubevirt-controller サービスアカウントの追加の SCC とパーミッション

SCC (Security Context Constraints) は Pod のパーミッションを制御します。これらのパーミッションには、コンテナーのコレクションである Pod が実行できるアクションおよびそれがアクセスできるリソース情報が含まれます。SCC を使用して、Pod がシステムに受け入れられるために必要な Pod の実行に関する条件の一覧を定義できます。

virt-controller は、クラスター内の仮想マシンの virt-launcher Pod を作成するクラスターコントローラーです。これらの Pod には、kubevirt-controller サービスアカウントによってパーミッションが付与されます。

kubevirt-controller サービスアカウントには追加の SCC および Linux 機能が付与され、これにより適切なパーミッションを持つ virt-launcher Pod を作成できます。これらの拡張パーミッションにより、仮想マシンは通常の Pod の範囲外の OpenShift Virtualization 機能を利用できます。

kubevirt-controller サービスアカウントには以下の SCC が付与されます。

-

scc.AllowHostDirVolumePlugin = true

これは、仮想マシンが hostpath ボリュームプラグインを使用することを可能にします。 -

scc.AllowPrivilegedContainer = false

これは、virt-launcher Pod が権限付きコンテナーとして実行されないようにします。 scc.AllowedCapabilities = []corev1.Capability{"SYS_NICE", "NET_BIND_SERVICE"}-

SYS_NICEを使用すると、CPU アフィニティーを設定できます。 -

NET_BIND_SERVICEは、DHCP および Slirp 操作を許可します。

-

kubevirt-controller の SCC および RBAC 定義の表示

oc ツールを使用して kubevirt-controller の SecurityContextConstraints 定義を表示できます。

$ oc get scc kubevirt-controller -o yaml

oc ツールを使用して kubevirt-controller クラスターロールの RBAC 定義を表示できます。

$ oc get clusterrole kubevirt-controller -o yaml1.4. OpenShift Virtualization アーキテクチャー

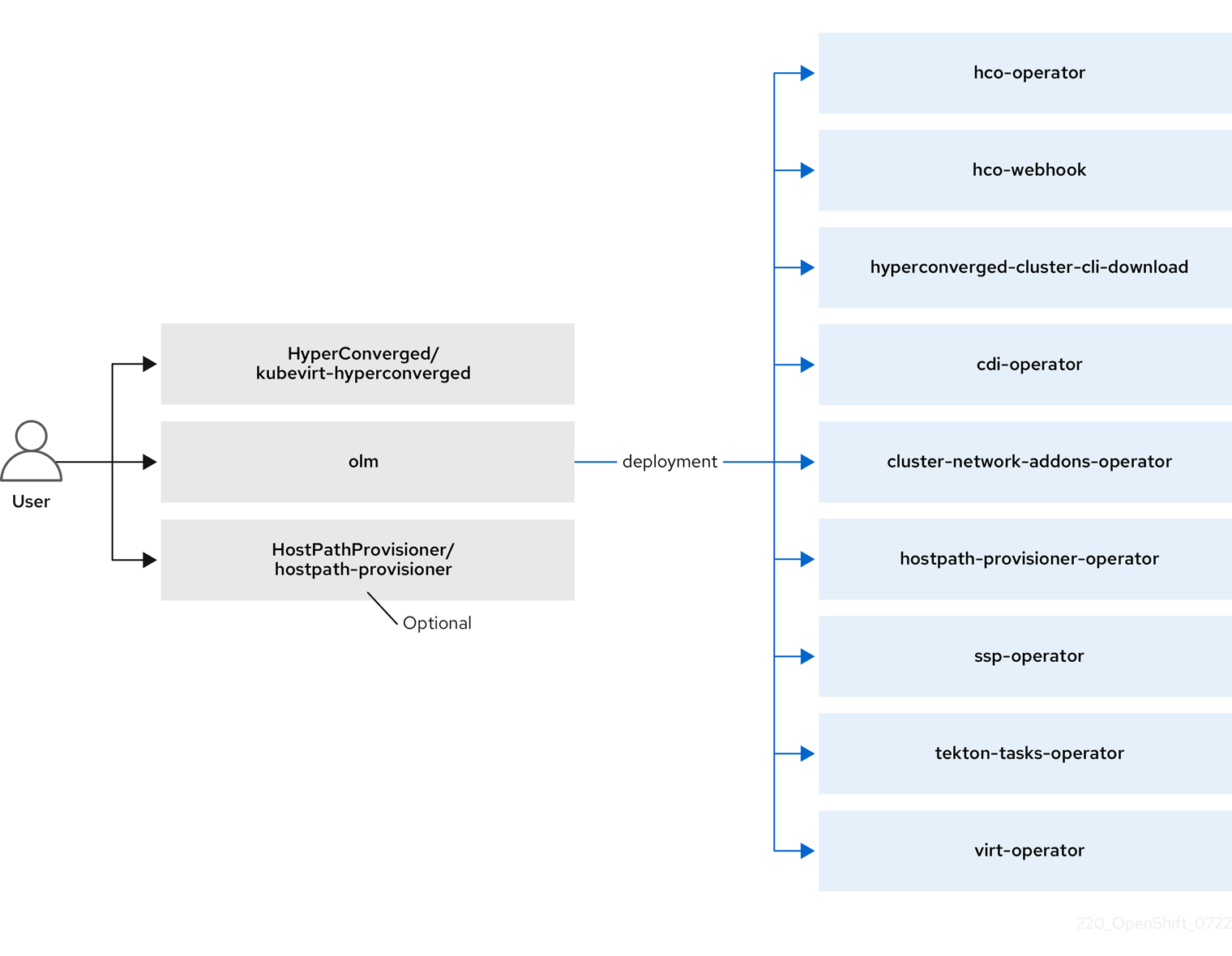

Operator Lifecycle Manager (OLM) は、OpenShift Virtualization の各コンポーネントのオペレーター Pod をデプロイします。

-

コンピューティング:

virt-operator -

ストレージ:

cdi-operator -

ネットワーク:

cluster-network-addons-operator -

スケーリング:

ssp-operator -

テンプレート作成:

tekton-tasks-operator

OLM は、他のコンポーネントのデプロイ、設定、およびライフサイクルを担当する hyperconverged-cluster-operator Pod と、いくつかのヘルパー Pod (hco-webhook および hyperconverged-cluster-cli-download) もデプロイします。

すべての Operator Pod が正常にデプロイされたら、HyperConverged カスタムリソース (CR) を作成する必要があります。HyperConverged CR で設定された設定は、信頼できる唯一の情報源および OpenShift Virtualization のエントリーポイントとして機能し、CR の動作をガイドします。

HyperConverged CR は、リコンシリエーションループに含まれる他の全コンポーネントの Operator に対して対応する CR を作成します。その後、各 Operator は、デーモンセット、config map、および OpenShift Virtualization コントロールプレーン用の追加コンポーネントなどのリソースを作成します。たとえば、HyperConverged Operator (HCO) が KubeVirt CR を作成すると、OpenShift Virtualization Operator がそれを調整し、virt-controller、virt-handler、virt-api などの追加リソースを作成します。

OLM は Hostpath Provisioner (HPP) Operator をデプロイしますが、hostpath-provisioner CR を作成するまで機能しません。

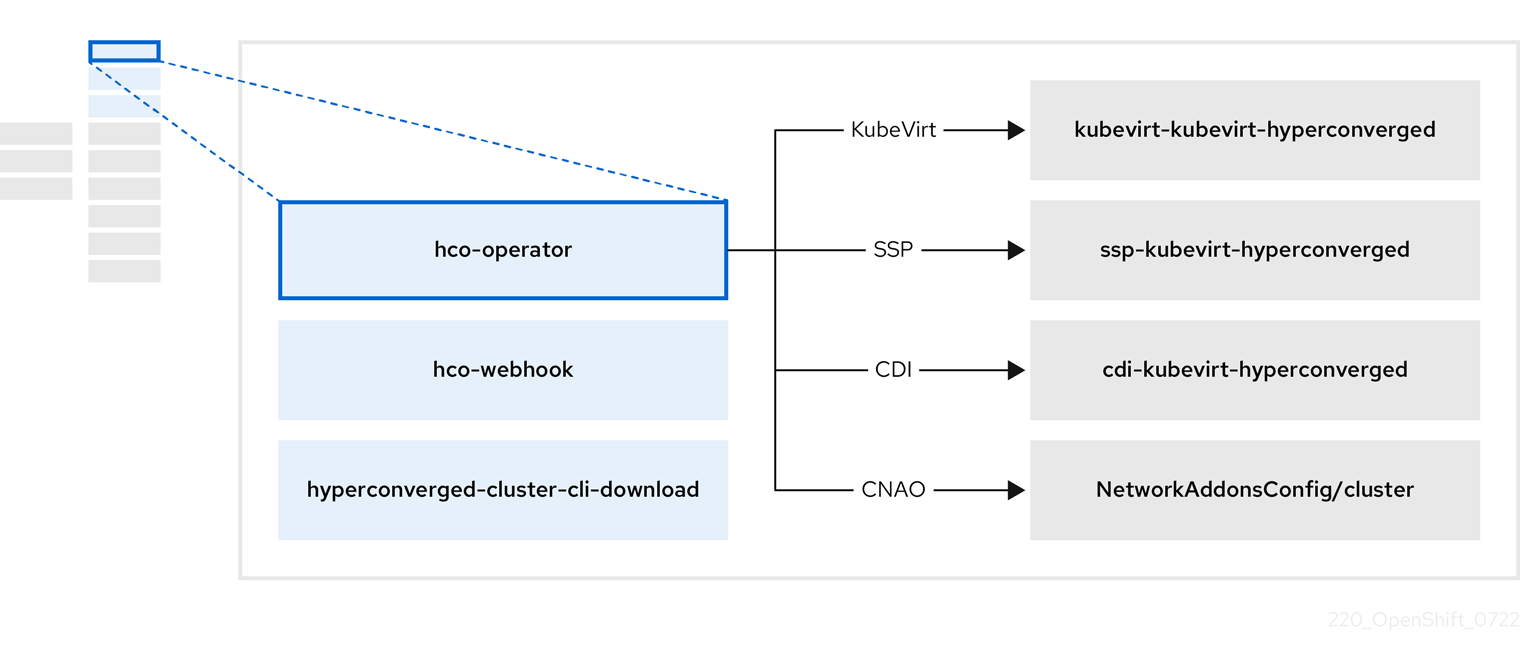

1.4.1. HyperConverged Operator (HCO) について

HCO (hco-operator) は、OpenShift Virtualization と複数のヘルパー Operator を、推奨のデフォルト設定を使用してデプロイおよび管理するための単一のエントリーポイントを提供します。また、これらの Operator のカスタムリソース (CR) も作成します。

| コンポーネント | 説明 |

|---|---|

|

|

|

|

|

クラスターから直接ダウンロードできるように、 |

|

| OpenShift Virtualization に必要なすべての Operator、CR、およびオブジェクトが含まれています。 |

|

| Scheduling, Scale, and Performance (SSP) CR。これは、HCO によって自動的に作成されます。 |

|

| Containerized Data Importer (CDI) CR。これは、HCO によって自動的に作成されます。 |

|

|

|

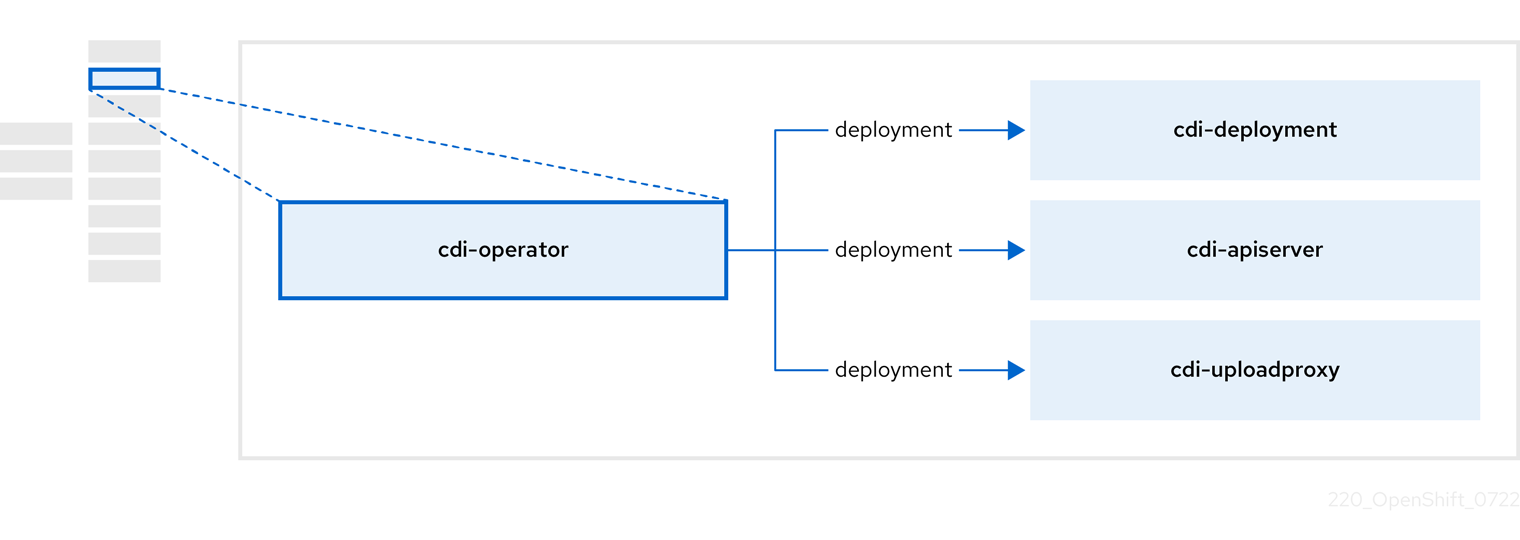

1.4.2. Containerized Data Importer (CDI) Operator について

CDI Operator cdi-operator は、CDI とその関連リソースを管理し、データボリュームを使用して仮想マシンイメージを永続ボリューム要求 (PVC) にインポートします。

| コンポーネント | 説明 |

|---|---|

|

| 安全なアップロードトークンを発行して、VM ディスクを PVC にアップロードするための承認を管理します。 |

|

| 外部ディスクのアップロードトラフィックを適切なアップロードサーバー Pod に転送して、正しい PVC に書き込むことができるようにします。有効なアップロードトークンが必要です。 |

|

| データボリュームの作成時に仮想マシンイメージを PVC にインポートするヘルパー Pod。 |

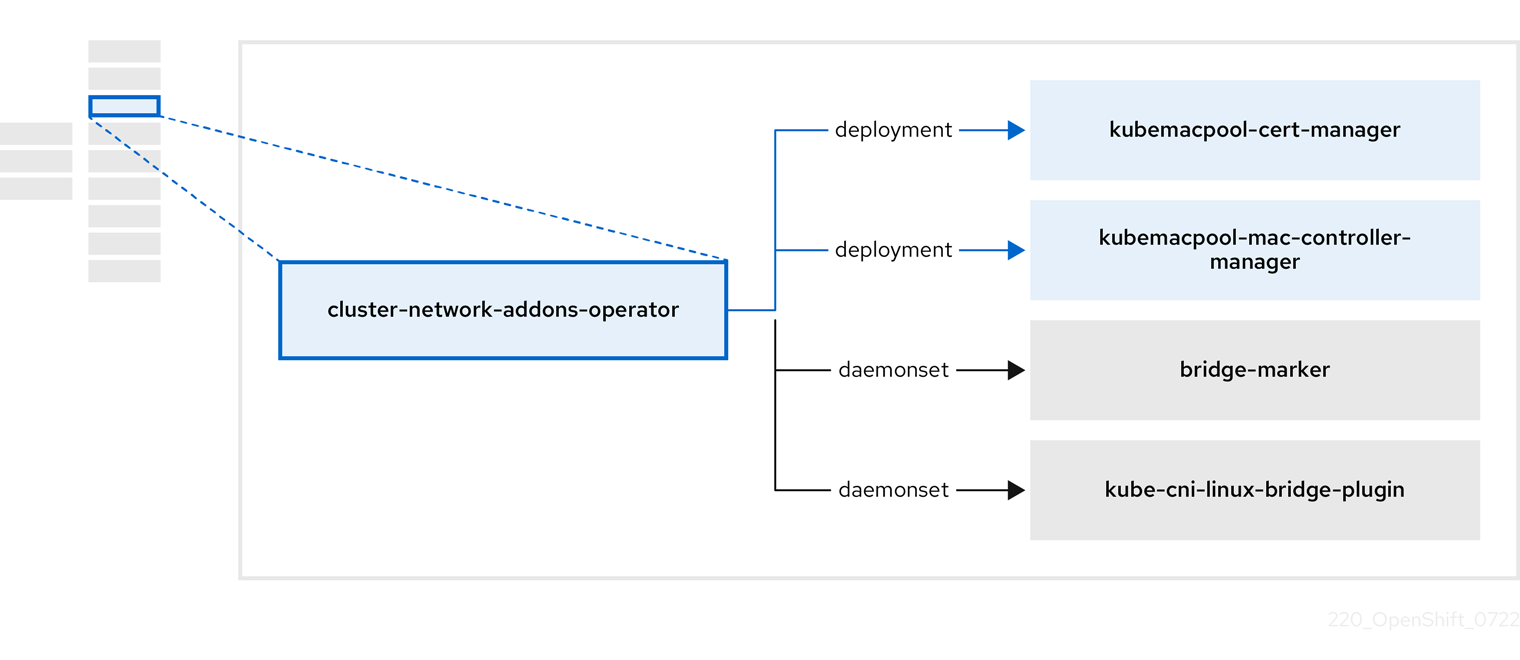

1.4.3. Cluster Network Addons Operator について

Cluster Network Addons Operator (cluster-network-addons-operator) は、クラスターにネットワークコンポーネントをデプロイし、拡張ネットワーク機能の関連リソースを管理します。

| コンポーネント | 説明 |

|---|---|

|

| Kubemacpool の Webhook の TLS 証明書を管理します。 |

|

| 仮想マシン (VM) ネットワークインターフェイスカード (NIC) の MAC アドレスプールサービスを提供します。 |

|

| ノードで使用可能なネットワークブリッジをノードリソースとしてマークします。 |

|

| クラスターノードに Container Network Interface (CNI) プラグインをインストールし、Network Attachment Definition を介して Linux ブリッジに VM を接続できるようにします。 |

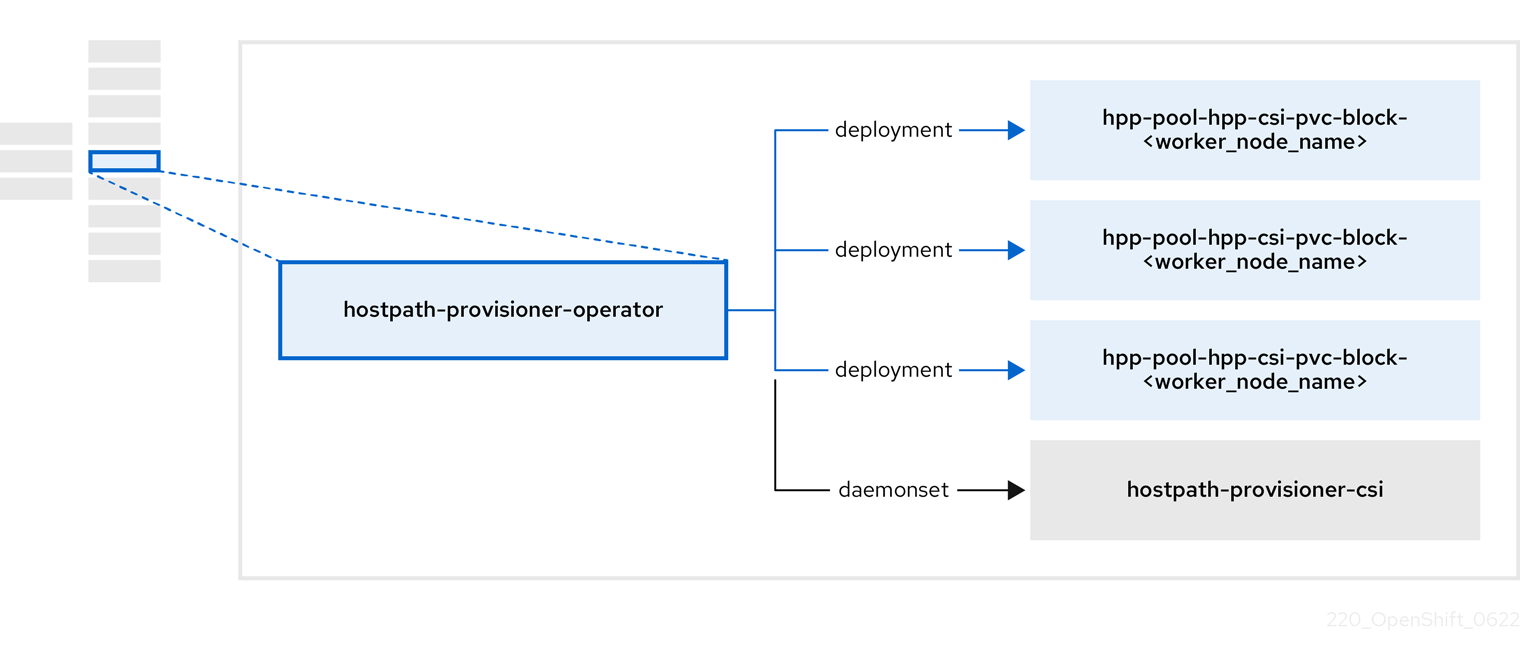

1.4.4. Hostpath Provisioner (HPP) Operator について

HPP オペレーター hostpath-provisioner-operator は、マルチノード HPP および関連リソースをデプロイおよび管理します。

| コンポーネント | 説明 |

|---|---|

|

| HPP の実行が指定されている各ノードにワーカーを提供します。Pod は、指定されたバッキングストレージをノードにマウントします。 |

|

| HPP の Container Storage Interface (CSI) ドライバーインターフェイスを実装します。 |

|

| HPP のレガシードライバーインターフェイスを実装します。 |

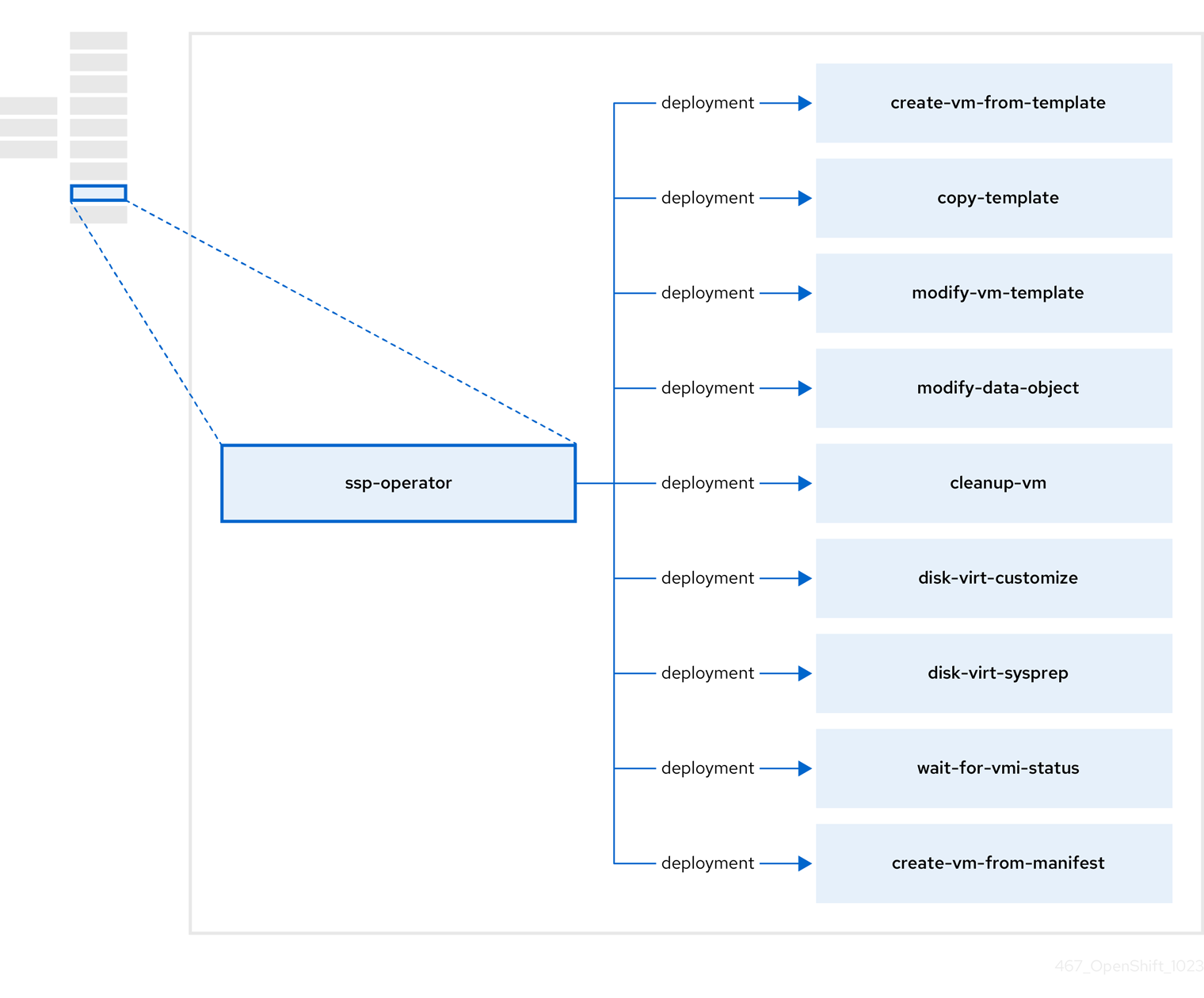

1.4.5. Scheduling, Scale, and Performance (SSP) Operator について

SSP オペレーター ssp-operator は、共通テンプレート、関連するデフォルトのブートソース、パイプラインタスク、およびテンプレートバリデーターをデプロイします。

| コンポーネント | 説明 |

|---|---|

|

| テンプレートから仮想マシンを作成します。 |

|

| 仮想マシンテンプレートをコピーします。 |

|

| 仮想マシンテンプレートを作成または削除します。 |

|

| データボリュームまたはデータソースを作成または削除します。 |

|

| 仮想マシンでスクリプトまたはコマンドを実行し、後で仮想マシンを停止または削除します。 |

|

|

|

|

|

|

|

| 特定の仮想マシンインスタンス (VMI) ステータスを待機し、そのステータスに応じて失敗または成功します。 |

|

| マニフェストから仮想マシンを作成します。 |

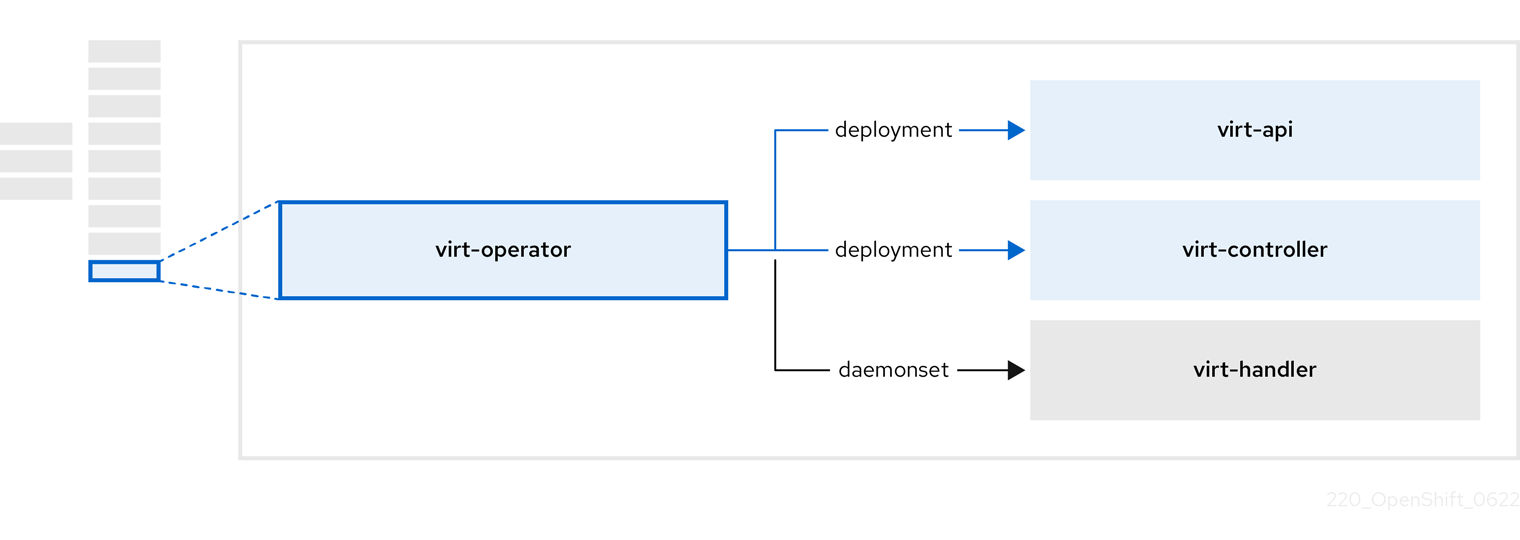

1.4.6. OpenShift Virtualization Operator について

OpenShift Virtualization Operator virt-operator は、現在の仮想マシンワークロードを中断することなく OpenShift Virtualization をデプロイ、アップグレード、管理します。

| コンポーネント | 説明 |

|---|---|

|

| すべての仮想化関連フローのエントリーポイントとして機能する HTTP API サーバー。 |

|

|

新しい VM インスタンスオブジェクトの作成を監視し、対応する Pod を作成します。Pod がノードでスケジュールされると、 |

|

|

仮想マシンへの変更を監視し、必要な操作を実行するように |

|

|

|

第2章 リリースノート

2.1. OpenShift Virtualization リリースノート

2.1.1. ドキュメントに関するフィードバックの提供

エラーを報告したり、ドキュメントを改善したりするには、Red Hat Jira アカウント にログインし、Jira issue を送信してください。

2.1.2. Red Hat OpenShift Virtualization について

Red Hat OpenShift Virtualization を使用すると、従来の仮想マシン (VM) を OpenShift Container Platform に導入し、コンテナーと一緒に実行できます。OpenShift Virtualization では、仮想マシンとは OpenShift Container Platform Web コンソールまたはコマンドラインを使用して管理できるネイティブ Kubernetes オブジェクトです。

OpenShift Virtualization は、

![]() アイコンで表されます。

アイコンで表されます。

OpenShift Virtualization は 、OVN-Kubernetes または OpenShiftSDN のデフォルトの Container Network Interface (CNI) ネットワークプロバイダーのいずれかで使用できます。

OpenShift Virtualization の機能 を参照してください。

OpenShift Virtualization のアーキテクチャーとデプロイメント の詳細を参照してください。

OpenShift Virtualization 用に クラスターを準備します。

2.1.2.1. OpenShift Virtualization サポートのクラスターバージョン

OpenShift Virtualization 4.15 の最新の安定リリースは 4.15.10 です。

OpenShift Virtualization 4.15 は、OpenShift Container Platform 4.15 クラスターでの使用がサポートされます。OpenShift Virtualization の最新の z-stream リリースを使用するには、最初に OpenShift Container Platform の最新バージョンにアップグレードする必要があります。

2.1.2.2. サポート対象のゲストオペレーティングシステム

OpenShift Virtualization でサポートされているゲストオペレーティングシステムを確認するには、Red Hat OpenStack Platform、Red Hat Virtualization、OpenShift Virtualization、Red Hat Enterprise Linux with KVM の認定ゲストオペレーティングシステム を参照してください。

2.1.2.3. Microsoft Windows SVVP 認定

OpenShift Virtualization は、Windows Server のワークロードを実行する Microsoft の Windows Server Virtualization Validation Program (SVVP) で認定されています。

SVVP 認定は以下に適用されます。

- Red Hat Enterprise Linux CoreOS ワーカー。Microsoft SVVP Catalog では、Red Hat OpenShift Container Platform 4 on RHEL CoreOS 9 という名前が付けられます。

- Intel および AMD CPU。

2.1.3. クイックスタート

クイックスタートツアーは、複数の OpenShift Virtualization 機能で利用できます。ツアーを表示するには、OpenShift Container Platform Web コンソールのヘッダーのメニューバーにある Help アイコン ? をクリックし、Quick Starts を選択します。Filter フィールドにキーワードとして virtualization を入力すると、利用可能なツアーをフィルタリングできます。

2.1.4. 新機能および変更された機能

このリリースでは、次のコンポーネントと概念に関連する新機能と機能拡張が追加されています。

2.1.4.1. インストールおよび更新

-

kubevirt_vm_created_totalメトリクス (型: Counter) を使用して、指定した namespace で作成された仮想マシンの数をクエリーできるようになりました。

2.1.4.2. Infrastructure

-

instanceTypeAPI は、より安定したv1beta1バージョンを使用するようになりました。

2.1.4.3. 仮想化

- トラブルシューティングを容易にするために、仮想マシンゲストのシリアルコンソールログ へのアクセスを有効化できるようになりました。この機能はデフォルトで無効化されています。クラスター管理者は、Web コンソールまたは CLI を使用して、仮想マシンのデフォルト設定を変更できます。ユーザーは、クラスター全体のデフォルト設定に関係なく、個々の仮想マシンでゲストログアクセスを切り替えることができます。

- フリーページレポートはデフォルトで有効になっています。

- ノードが過負荷になった場合、kernel samepage merging (KSM)\) をアクティブ化 するように OpenShift Virtualization を設定できます。

2.1.4.4. ネットワーク

- 実行中の仮想マシンに、セカンダリーネットワークインターフェイスをホットプラグ できます。ホットプラグとホットアンプラグは、OpenShift Virtualization 4.14 以降で作成された仮想マシンでのみサポートされます。ホットアンプラグは、Single Root I/O Virtualization (SR-IOV) インターフェイスではサポートされていません。

- OpenShift Virtualization は、OVN-Kubernetes セカンダリーネットワーク のローカルネットトポロジーをサポートするようになりました。ローカルネットトポロジーは、セカンダリーネットワークを物理アンダーレイに接続します。これにより、east-west クラスタートラフィックとクラスター外で実行されているサービスへのアクセスの両方が可能になります。ただし、クラスターノード上の基盤となる Open vSwitch (OVS) システムの追加設定が必要です。

-

OVN-Kubernetes セカンダリーネットワークは、仮想マシンとの間のトラフィックフローを制御する

MultiNetworkPolicyカスタムリソース定義(CRD)を提供する マルチネットワークポリシー API と互換性があります。ipBlock属性を使用して、特定の CIDR ブロックに対するネットワークポリシーの受信および送信ルールを定義できます。

- 以前はテクノロジープレビュー機能であった SR-IOV での DPDK ワークロード用のクラスター設定 は、現在、一般提供されています。

2.1.4.5. ストレージ

-

データボリュームのクローン作成時に特定の前提条件が満たされている場合、 Containerized Data Importer (CDI)) は効率的な Container Storage Interface (CSI) クローンを選択します。効率性の低い方法であるホスト支援型クローン作成がフォールバックとして使用されます。ホスト支援型クローン作成が使用される理由については、クローンが作成された永続ボリューム要求 (PVC) の

cdi.kubevirt.io/cloneFallbackReasonアノテーションを確認でしてください。

2.1.4.6. Web コンソール

- カスタマイズされたインスタンス型 と環境設定をインストールおよび編集し、ボリュームまたは永続ボリューム要求 (PVC) から仮想マシンを作成する機能はテクノロジープレビュー機能でしたが、現在は一般提供されています。

- Preview features タブは、Virtualization → Overview → Settings にあります。

通常の仮想マシンまたは LUN バックアップ仮想マシンディスクのディスク共有を設定することで、複数の仮想マシンが基礎となる同じストレージを共有できます。共有するディスクはすべてブロックモードである必要があります。

LUN バックアップのブロックモード仮想マシンディスクを複数の仮想マシン間で共有可能にするには、クラスター管理者は SCSI

PersistentReservationフィーチャーゲートを有効にする必要があります。詳細は、仮想マシンの共有ボリュームを設定する を参照してください。

- VirtualMachine details ページの Configuration タブで、仮想マシンの設定を検索できるようになりました。

- Virtualization → Overview → Settings → Cluster → General settings → SSH configurations で、SSH over NodePort service を設定できるようにあんりました。

- インスタンス型から仮想マシンを作成する場合、OpenShift Container Platform Web コンソールのボリュームリストでお気に入りの起動可能ボリュームにスターを付けて指定できるようになりました。

- Web コンソールを使用して、仮想マシンの 遅延チェック を実行できます。サイドメニューから、Virtualization → Checkups → Network latency をクリックします。初めてチェックを実行する場合は、Install permissions、Run checkup の順にクリックします。

- Web コンソールを使用して、ストレージ検証の チェック を実行できます。サイドメニューから、Virtualization → Checkups → Storage をクリックします。初めてチェックを実行する場合は、Install permissions、Run checkup の順にクリックします。

- Web コンソール を使用して、すべてのクラスターノードの kernel samepage merging (KSM) アクティベーション機能 を有効または無効にできます。

- Web コンソールを使用して、Single Root I/O Virtualization (SR-IOV) インターフェイスを実行中の仮想マシンにホットプラグできるようになりました。

- 仮想マシンの作成時に公開 SSH キーを追加する 場合、または 既存の仮想マシンにシークレットを追加する 場合に、他のプロジェクトの既存シークレットを使用できるようになりました。

- OpenShift Container Platform Web コンソールを使用して、OVN-Kubernetes ローカルネットトポロジーのネットワーク接続定義 (NAD) を作成 できるようになりました。

2.1.5. 非推奨の機能と削除された機能

2.1.5.1. 非推奨の機能

非推奨の機能は現在のリリースに含まれており、サポートされています。ただし、これらは今後のリリースで削除されるため、新規デプロイメントでの使用は推奨されません。

-

tekton-tasks-operatorは非推奨になり、Tekton タスクとサンプルパイプラインはssp-operatorによってデプロイされるようになりました。

-

copy-template、modify-vm-template、およびcreate-vm-from-templateタスクは非推奨になりました。

- Windows Server 2012 R2 テンプレートのサポートは廃止されました。

2.1.5.2. 削除された機能

削除された機能は、現在のリリースではサポートされません。

- 従来の HPP カスタムリソースと関連するストレージクラスのサポートは、すべての新しいデプロイメントで削除されました。OpenShift Virtualization 4.15 では、HPP Operator は Kubernetes Container Storage Interface (CSI) ドライバーを使用してローカルストレージを設定します。レガシー HPP カスタムリソースは、以前のバージョンの OpenShift Virtualization にインストールされていた場合にのみサポートされます。

- 現在、CentOS 7 および CentOS Stream 8 はライフサイクル終了段階にあります。そのため、これらのオペレーティングシステムのコンテナーイメージは OpenShift Virtualization から削除され、コミュニティーによるサポート もありません。

2.1.6. テクノロジープレビュー機能

現在、今回のリリースに含まれる機能にはテクノロジープレビューのものがあります。これらの実験的機能は、実稼働環境での使用を目的としていません。これらの機能に関しては、Red Hat カスタマーポータルの以下のサポート範囲を参照してください。

- クラスター全体 の 仮想マシンエビクションストラテジー を設定できるようになりました。

- OpenShift Virtualization ホストでネストされた仮想化 を有効化できるようになりました。

- クラスター管理者は、OpenShift Container Platform Web コンソールの Overview → Settings → Cluster → Preview features で、namespace の CPU リソース制限を有効にできるようになりました。

2.1.7. バグ修正

-

以前は、

volumeBindingModeがWaitForFirstConsumerに設定されているストレージクラスで起動すると、windows-efi-installerパイプラインが失敗していました。今回の修正により、パイプラインが失敗する原因となっていたStorageClassオブジェクト内のアノテーションが削除されました。(CNV-32287) -

以前は、

openshift-virtualization-os-imagesnamespace で提供されたデータソースを使用して約 1,000 個の仮想マシンのクローンを同時に作成すると、一部の仮想マシンが実行状態に遷移しませんでした。今回の修正により、多数の 仮想マシンのクローンを同時に作成できるようになりました。(CNV-30083) -

以前は、

install-config.yamlファイルでnetworkType: OVNKubernetesを使用している場合、Web コンソールに表示されるNodePortサービスとそれに関連付けられた完全修飾ドメイン名 (FQDN) を使用して仮想マシンに SSH 接続できませんでした。今回の更新により、SSHNodePortサービスの有効なアクセス可能エンドポイントを表示するように、Web コンソールを設定できるようになりました。(CNV-24889) - 今回の更新により、仮想ディスクのホットプラグ後に仮想マシンインスタンス (VMI) のライブマイグレーションが失敗しなくなりました。(CNV-34761)

2.1.8. 既知の問題

モニタリング

Pod Disruption Budget (PDB) は、移行可能な仮想マシンイメージに関する Pod の中断を防ぎます。PDB が Pod の中断を検出する場合、

openshift-monitoringはLiveMigrateエビクションストラテジーを使用する仮想マシンイメージに対して 60 分ごとにPodDisruptionBudgetAtLimitアラートを送信します。(CNV-33834)- 回避策として、アラートをサイレンス にします。

ネットワーク

OpenShift Container Platform 4.12 から新しいマイナーバージョンに更新すると、

cnv-bridgeContainer Network Interface (CNI) を使用する仮想マシンがライブマイグレーションに失敗します。(https://access.redhat.com/solutions/7069807)-

回避策として、更新を実行する前に、

NetworkAttachmentDefinitionマニフェストのspec.config.typeフィールドをcnv-bridgeからbridgeに変更します。

-

回避策として、更新を実行する前に、

Nodes

-

OpenShift Virtualization をアンインストールしても、OpenShift Virtualization によって作成された

feature.node.kubevirt.ioノードラベルは削除されません。ラベルは手動で削除する必要があります。(CNV-38543)

- さまざまなコンピュートノードが含まれる異種クラスターでは、HyperV reenlightenment が有効な仮想マシンを、タイムスタンプカウンター (TSC) スケーリングをサポートしていないノードまたは TSC の周波数が不適切なノードでスケジュールできません。(BZ#2151169)

ストレージ

AWS 上のストレージソリューションとして Portworx を使用し、仮想マシンのディスクイメージを作成する場合、ファイルシステムのオーバーヘッドが 2 回考慮されるため、作成されるイメージは予想よりも小さくなる可能性があります。(CNV-32695)

- 回避策として、最初のプロビジョニングプロセスが完了した後に、永続ボリューム要求 (PVC) を手動で拡張して利用可能なスペースを増やせます。

場合によっては、複数の仮想マシンが読み取り/書き込みモードで同じ PVC をマウントできるため、データが破損する可能性があります。(CNV-13500)

- 回避策として、複数の仮想マシンで読み取り/書き込みモードで単一の PVC を使用しないでください。

csi-cloneクローンストラテジーを使用して 100 台以上の仮想マシンのクローンを作成する場合、Ceph CSI はクローンをパージしない可能性があります。クローンの手動削除も失敗する可能性があります。(CNV-23501)-

回避策として、

ceph-mgrを再起動して仮想マシンのクローンをパージすることができます。

-

回避策として、

仮想化

-

カスタムリソース定義(CRD)がないため、OpenShift Virtualization 4.15 の一部のバージョンは Red Hat OpenShift Pipelines 1.19 と互換性がありません。問題を回避するには、OpenShift Pipelines 1.18 を使用します。または、OpenShift Pipelines 1.19 に更新する前に、

deployTektonTaskResourcesフィーチャーゲートをfalseに設定します。(CNV-66487)

qemu-kvmの重大なバグにより、ディスクのホットプラグ 操作後に仮想マシンがハングし、I/O エラーが発生します。この問題は、オペレーティングシステムディスクや、ホットプラグ操作に関与していない他のディスクにも影響を与える可能性があります。オペレーティングシステムディスクが動作を停止すると、ルートファイルシステムがシャットダウンします。詳細は、Red Hat ナレッジベース Virtual Machine loses access to its disks after hot-plugging some extra disks を参照してください。重要パッケージのバージョン管理により、OpenShift Virtualization を 4.13.z または 4.14.z から 4.15.0 に更新すると、このバグが再発する可能性があります。

-

仮想 Trusted Platform Module (vTPM) デバイスを Windows 仮想マシンに追加すると、vTPM デバイスが永続的でない場合でも、BitLocker ドライブ暗号化システムチェックに合格します。これは、

virt-launcherPod の存続期間中、永続的ではない vTPM デバイスが一時ストレージを使用して暗号化キーを保存および復元するためです。仮想マシンが移行するか、シャットダウンして再起動すると、vTPM データは失われます。(CNV-36448)

OpenShift Virtualization は、Pod によって使用されるサービスアカウントトークンをその特定の Pod にリンクします。OpenShift Virtualization は、トークンが含まれるディスクイメージを作成してサービスアカウントボリュームを実装します。仮想マシンを移行すると、サービスアカウントボリュームが無効になります。(CNV-33835)

- 回避策として、サービスアカウントではなくユーザーアカウントを使用してください。ユーザーアカウントトークンは特定の Pod にバインドされていないためです。

RHSA-2023:3722 アドバイザリーのリリースにより、FIPS 対応 Red Hat Enterprise Linux (RHEL) 9 システム上の TLS 1.2 接続には TLS

Extended Master Secret(EMS) 拡張機能 (RFC 7627) が必須になりました。これは FIPS-140-3 要件に準拠しています。TLS 1.3 は影響を受けません。EMS または TLS 1.3 をサポートしていないレガシー OpenSSL クライアントは、RHEL 9 で実行されている FIPS サーバーに接続できなくなりました。同様に、FIPS モードの RHEL 9 クライアントは、EMS なしでは TLS 1.2 のみをサポートするサーバーに接続できません。これは実際には、これらのクライアントが RHEL 6、RHEL 7、および RHEL 以外のレガシーオペレーティングシステム上のサーバーに接続できないことを意味します。これは、OpenSSL のレガシー 1.0.x バージョンが EMS または TLS 1.3 をサポートしていないためです。詳細は、TLS Extension "Extended Master Secret" enforced with Red Hat Enterprise Linux 9.2 を参照してください。

-

回避策として、レガシー OpenSSL クライアントを TLS 1.3 をサポートするバージョンに更新し、FIPS モードの場合に OpenShift Virtualization が

ModernTLS セキュリティープロファイル型で TLS 1.3 を使用するようにを設定します。

-

回避策として、レガシー OpenSSL クライアントを TLS 1.3 をサポートするバージョンに更新し、FIPS モードの場合に OpenShift Virtualization が

Web コンソール

cluster-admin権限がない場合、OpenShift Container Platform クラスターの初回デプロイ時に、Web コンソールを使用してテンプレートまたはインスタンスタイプから仮想マシンを作成すると失敗します。- 回避策として、クラスター管理者はまず 設定マップを作成 して、他のユーザーがテンプレートとインスタンスタイプを使用して仮想マシンを作成できるようにする必要があります(リンク: CNV-38284)。

Web コンソールを使用して OVN-Kubernetes ローカルネットトポロジーのネットワーク接続定義 (NAD) を作成すると、無効なアノテーション

k8s.v1.cni.cncf.io/resourceName: openshift.io/が表示されます。このアノテーションにより、仮想マシンの起動が妨げられます。- 回避策として、アノテーションを削除します。

第3章 スタートガイド

3.1. OpenShift Virtualization の開始

基本的な環境をインストールして設定することにより、OpenShift Virtualization の特徴と機能を調べることができます。

クラスター設定手順には、cluster-admin 権限が必要です。

3.1.1. OpenShift Virtualization の計画とインストール

OpenShift Container Platform クラスターで OpenShift Virtualization を計画およびインストールします。

計画およびインストールのリソース

3.1.2. 仮想マシンの作成と管理

仮想マシンを作成します。

Red Hat テンプレートまたは インスタンスタイプ を使用して仮想マシンを作成できます。

仮想マシンを作成するには、コンテナーレジストリーまたは Web ページからカスタムイメージをインポートするか、ローカルマシンからイメージをアップロードするか、永続ボリューム要求 (PVC) を複製することによって実行できます。

仮想マシンをセカンダリーネットワークに接続します。

- Linux ブリッジネットワーク。

- オープン仮想ネットワーク (OVN)- Kubernetes セカンダリーネットワーク。

シングルルート I/O 仮想化 (SR-IOV) ネットワーク。

注記仮想マシンはデフォルトで Pod ネットワークに接続されます。

仮想マシンに接続します。

- 仮想マシンの シリアルコンソール または VNC コンソール に接続します。

- SSH を使用して仮想マシンに接続します。

- Windows 仮想マシンのデスクトップビューアーに接続します。

仮想マシンを管理します。

3.1.3. 次のステップ

3.2. virtctl および libguestfs CLI ツールの使用

virtctl コマンドラインツールを使用して、OpenShift Virtualization リソースを管理できます。

libguestfs コマンドラインツールを使用すると、仮想マシン (VM) のディスクイメージにアクセスして変更できます。libguestfs をデプロイするには、virtctl libguestfs コマンドを使用します。

3.2.1. virtctl のインストール

Red Hat Enterprise Linux (RHEL) 9、Linux、Windows、および MacOS オペレーティングシステムに virtctl をインストールするには、virtctl バイナリーファイルをダウンロードしてインストールします。

RHEL 8 に virtctl をインストールするには、OpenShift Virtualization リポジトリーを有効にしてから、kubevirt-virtctl パッケージをインストールします。

3.2.1.1. RHEL 9、Linux、Windows、macOS への virtctl バイナリーのインストール

OpenShift Container Platform Web コンソールからオペレーティングシステムの virtctl バイナリーをダウンロードし、それをインストールできます。

手順

- Web コンソールの Virtualization → Overview ページに移動します。

-

Download virtctl リンクをクリックして、オペレーティングシステム用の

virtctlバイナリーをダウンロードします。 virtctlをインストールします。RHEL 9 およびその他の Linux オペレーティングシステムの場合:

アーカイブファイルを解凍します。

$ tar -xvf <virtctl-version-distribution.arch>.tar.gz次のコマンドを実行して、

virtctlバイナリーを実行可能にします。$ chmod +x <path/virtctl-file-name>virtctlバイナリーをPATH環境変数内のディレクトリーに移動します。次のコマンドを実行して、パスを確認できます。

$ echo $PATHKUBECONFIG環境変数を設定します。$ export KUBECONFIG=/home/<user>/clusters/current/auth/kubeconfig

Windows の場合:

- アーカイブファイルを展開します。

-

展開したフォルダー階層に移動し、

virtctl実行可能ファイルをダブルクリックしてクライアントをインストールします。 virtctlバイナリーをPATH環境変数内のディレクトリーに移動します。次のコマンドを実行して、パスを確認できます。

C:\> path

macOS の場合:

- アーカイブファイルを展開します。

virtctlバイナリーをPATH環境変数内のディレクトリーに移動します。次のコマンドを実行して、パスを確認できます。

echo $PATH

3.2.1.2. RHEL 8 への virtctl RPM のインストール

OpenShift Virtualization リポジトリーを有効にし、kubevirt-virtctl パッケージをインストールすることで、Red Hat Enterprise Linux (RHEL) 8 に virtctl RPM をインストールできます。

前提条件

- クラスター内の各ホストは Red Hat Subscription Manager (RHSM) に登録されており、アクティブな OpenShift Container Platform サブスクリプションを持つ必要があります。

手順

subscription-managerCLI ツールを使用して次のコマンドを実行し、OpenShift Virtualization リポジトリーを有効にします。# subscription-manager repos --enable cnv-4.15-for-rhel-8-x86_64-rpms次のコマンドを実行して、

kubevirt-virtctlパッケージをインストールします。# yum install kubevirt-virtctl

3.2.2. virtctl コマンド

virtctl クライアントは、OpenShift Virtualization リソースを管理するためのコマンドラインユーティリティーです。

特に指定がない限り、仮想マシンコマンドは仮想マシンインスタンスにも適用されます。

3.2.2.1. virtctl 情報コマンド

virtctl information コマンドを使用して、virtctl クライアントに関する情報を表示します。

| コマンド | 説明 |

|---|---|

|

|

|

|

|

|

|

| 特定のコマンドのオプションのリストを表示します。 |

|

|

任意の |

3.2.2.2. 仮想マシン情報コマンド

virtctl を使用すると、仮想マシンおよび仮想マシンインスタンス (VMI) に関する情報を表示できます。

| コマンド | 説明 |

|---|---|

|

| ゲストマシンで使用可能なファイルシステムを表示します。 |

|

| ゲストマシンのオペレーティングシステムに関する情報を表示します。 |

|

| ゲストマシンにログインしているユーザーを表示します。 |

3.2.2.3. 仮想マシンマニフェスト作成コマンド

virtctl create コマンドを使用して、仮想マシン、インスタンスタイプ、および設定のマニフェストを作成できます。

| コマンド | 説明 |

|---|---|

|

|

|

| 仮想マシンの名前を指定して、仮想マシンのマニフェストを作成します。 |

|

| 既存のクラスター全体のインスタンスの種類を使用する仮想マシンのマニフェストを作成します。 |

|

| 既存の namespaced 付きのインスタンスタイプを使用する仮想マシンのマニフェストを作成します。 |

|

| クラスター全体のインスタンスタイプのマニフェストを作成します。 |

|

| namespace 付きのインスタンスタイプのマニフェストを作成します。 |

|

| 設定の名前を指定して、クラスター全体の仮想マシン設定のマニフェストを作成します。 |

|

| namespace 付きの仮想マシン設定のマニフェストを作成します。 |

3.2.2.4. 仮想マシン管理コマンド

virtctl 仮想マシン管理コマンドを使用して、仮想マシンおよび仮想マシンインスタンスを管理および移行します。

| コマンド | 説明 |

|---|---|

|

| 仮想マシンを開始します。 |

|

| 仮想マシンを一時停止状態で起動します。このオプションを使用すると、VNC コンソールからブートプロセスを中断できます。 |

|

| 仮想マシンを停止します。 |

|

| 仮想マシンを強制停止します。このオプションは、データの不整合またはデータ損失を引き起こす可能性があります。 |

|

| 仮想マシンを一時停止します。マシンの状態がメモリーに保持されます。 |

|

| 仮想マシンの一時停止を解除します。 |

|

| 仮想マシンを移行します。 |

|

| 仮想マシンの移行をキャンセルします。 |

|

| 仮想マシンを再起動します。 |

3.2.2.5. 仮想マシン接続コマンド

virtctl 接続コマンドを使用してポートを公開し、仮想マシンおよび仮想マシンインスタンスに接続します。

| コマンド | 説明 |

|---|---|

|

| 仮想マシンのシリアルコンソールに接続します。 |

|

| 仮想マシンの指定されたポートを転送するサービスを作成し、ノードの指定されたポートでサービスを公開します。

例: |

|

| マシンから仮想マシンにファイルをコピーします。このコマンドは、SSH 鍵ペアの秘密鍵を使用します。仮想マシンは公開鍵を使用して設定する必要があります。 |

|

| 仮想マシンからマシンにファイルをコピーします。このコマンドは、SSH 鍵ペアの秘密鍵を使用します。仮想マシンは公開鍵を使用して設定する必要があります。 |

|

| 仮想マシンとの SSH 接続を開きます。このコマンドは、SSH 鍵ペアの秘密鍵を使用します。仮想マシンは公開鍵を使用して設定する必要があります。 |

|

| 仮想マシンの VNC コンソールに接続します。

|

|

| ポート番号を表示し、VNC 接続を介してビューアーを使用して手動で VM に接続します。 |

|

| ポートが利用可能な場合、その指定されたポートでプロキシーを実行するためにポート番号を指定します。 ポート番号が指定されていない場合、プロキシーはランダムポートで実行されます。 |

3.2.2.6. 仮想マシンエクスポートコマンド

virtctl vmexport コマンドを使用して、仮想マシン、仮想マシンスナップショット、または永続ボリューム要求 (PVC) からエクスポートされたボリュームを作成、ダウンロード、または削除できます。特定のマニフェストには、OpenShift Virtualization が使用できる形式でディスクイメージをインポートするためのエンドポイントへのアクセスを許可するヘッダーシークレットも含まれています。

| コマンド | 説明 |

|---|---|

|

|

仮想マシン、仮想マシンスナップショット、または PVC からボリュームをエクスポートするには、

|

|

|

|

|

|

オプション:

|

|

|

|

|

| 既存のエクスポートのマニフェストを取得します。マニフェストにはヘッダーシークレットが含まれていません。 |

|

| 仮想マシンサンプルの仮想マシンエクスポートを作成し、マニフェストを取得します。マニフェストにはヘッダーシークレットが含まれていません。 |

|

| 仮想マシンスナップショットの例の仮想マシンエクスポートを作成し、マニフェストを取得します。マニフェストにはヘッダーシークレットが含まれていません。 |

|

| 既存のエクスポートのマニフェストを取得します。マニフェストにはヘッダーシークレットが含まれています。 |

|

| 既存のエクスポートのマニフェストを json 形式で取得します。マニフェストにはヘッダーシークレットが含まれていません。 |

|

| 既存のエクスポートのマニフェストを取得します。マニフェストにはヘッダーシークレットが含まれており、指定されたファイルにそれを書き込みます。 |

3.2.2.7. 仮想マシンメモリーダンプコマンド

virtctl memory-dump コマンドを使用して、PVC に仮想マシンのメモリーダンプを出力できます。既存の PVC を指定するか、--create-claim フラグを使用して新しい PVC を作成できます。

前提条件

-

PVC ボリュームモードは

FileSystemである必要があります。 PVC は、メモリーダンプを格納するのに十分な大きさである必要があります。

PVC サイズを計算する式は

(VMMemorySize + 100Mi) * FileSystemOverheadです。ここで、100Miはメモリーダンプのオーバーヘッドです。次のコマンドを実行して、

HyperConvergedカスタムリソースでホットプラグフィーチャーゲートを有効にする必要があります。$ oc patch hyperconverged kubevirt-hyperconverged -n openshift-cnv \ --type json -p '[{"op": "add", "path": "/spec/featureGates", \ "value": "HotplugVolumes"}]'

メモリーダンプのダウンロード

メモリーダンプをダウンロードするには、virtctl vmexport download コマンドを使用する必要があります。

$ virtctl vmexport download <vmexport_name> --vm|pvc=<object_name> \

--volume=<volume_name> --output=<output_file>| コマンド | 説明 |

|---|---|

|

|

仮想マシンのメモリーダンプを PVC に保存します。メモリーダンプのステータスは、 オプション:

|

|

|

同じ PVC で このコマンドは、以前のメモリーダンプを上書きします。 |

|

| メモリーダンプを削除します。 ターゲット PVC を変更する場合は、メモリーダンプを手動で削除する必要があります。

このコマンドは、 |

3.2.2.8. ホットプラグおよびホットアンプラグコマンド

virtctl を使用して、実行中の仮想マシンおよび仮想マシンインスタンス (VMI) にリソースを追加または削除します。

| コマンド | 説明 |

|---|---|

|

| データボリュームまたは永続ボリューム要求 (PVC) をホットプラグします。 オプション:

|

|

| 仮想ディスクをホットアンプラグします。 |

|

| Linux ブリッジネットワークインターフェイスをホットプラグします。 |

|

| Linux ブリッジネットワークインターフェイスをホットアンプラグします。 |

3.2.2.9. イメージアップロードコマンド

virtctl image-upload コマンドを使用して、VM イメージをデータボリュームにアップロードできます。

| コマンド | 説明 |

|---|---|

|

| VM イメージを既存のデータボリュームにアップロードします。 |

|

| 指定された要求されたサイズの新しいデータボリュームに VM イメージをアップロードします。 |

3.2.3. virtctl を使用した libguestfs のデプロイ

virtctl guestfs コマンドを使用して、libguestfs-tools および永続ボリューム要求 (PVC) がアタッチされた対話型コンテナーをデプロイできます。

手順

libguestfs-toolsでコンテナーをデプロイして PVC をマウントし、シェルを割り当てるには、以下のコマンドを実行します。$ virtctl guestfs -n <namespace> <pvc_name>1 - 1

- PVC 名は必須の引数です。この引数を追加しないと、エラーメッセージが表示されます。

3.2.3.1. Libguestfs および virtctl guestfs コマンド

Libguestfs ツールは、仮想マシン (VM) のディスクイメージにアクセスして変更するのに役立ちます。libguestfs ツールを使用して、ゲスト内のファイルの表示および編集、仮想マシンのクローンおよびビルド、およびディスクのフォーマットおよびサイズ変更を実行できます。

virtctl guestfs コマンドおよびそのサブコマンドを使用して、PVC で仮想マシンディスクを変更して検査し、デバッグすることもできます。使用可能なサブコマンドの完全なリストを表示するには、コマンドラインで virt- と入力して Tab を押します。以下に例を示します。

| コマンド | 説明 |

|---|---|

|

| ターミナルでファイルを対話的に編集します。 |

|

| ゲストに ssh 鍵を注入し、ログインを作成します。 |

|

| 仮想マシンによって使用されるディスク容量を確認します。 |

|

| 完全なリストを含む出力ファイルを作成して、ゲストにインストールされているすべての RPM の全リストを表示します。 |

|

|

ターミナルで |

|

| テンプレートとして使用する仮想マシンディスクイメージをシールします。 |

デフォルトでは、virtctl guestfs は、仮想ディスク管理に必要な項目を含めてセッションを作成します。ただし、動作をカスタマイズできるように、コマンドは複数のフラグオプションもサポートしています。

| フラグオプション | 説明 |

|---|---|

|

|

|

|

| 特定の namespace から PVC を使用します。

|

|

|

|

|

|

デフォルトでは、

クラスターに

設定されていない場合、 |

|

|

|

このコマンドは、PVC が別の Pod によって使用されているかどうかを確認します。使用されている場合には、エラーメッセージが表示されます。ただし、libguestfs-tools プロセスが開始されると、設定では同じ PVC を使用する新規 Pod を回避できません。同じ PVC にアクセスする仮想マシンを起動する前に、アクティブな virtctl guestfs Pod がないことを確認する必要があります。

virtctl guestfs コマンドは、インタラクティブな Pod に割り当てられている PVC 1 つだけを受け入れます。

3.3. Web コンソールの概要

OpenShift Container Platform Web コンソールの Virtualization セクションには、OpenShift Virtualization 環境を管理および監視するための以下のページが含まれています。

| ページ | 説明 |

|---|---|

| OpenShift Virtualization 環境を管理および監視します。 | |

| テンプレートのカタログから仮想マシンを作成します。 | |

| 仮想マシンを作成および管理します。 | |

| テンプレートを作成および管理します。 | |

| 仮想マシンのインスタンスタイプを作成および管理します。 | |

| 仮想マシンの設定を作成および管理します。 | |

| ブート可能ボリュームの DataSources を作成および管理します。 | |

| ワークロードの移行ポリシーを作成および管理します。 | |

| 仮想マシンのネットワーク遅延とストレージのチェックを実行します。 |

| アイコン | 説明 |

|---|---|

|

| Edit アイコン |

|

| Link アイコン |

|

| Start VM アイコン |

|

| Stop VM アイコン |

|

| Restart VM アイコン |

|

| Pause VM アイコン |

|

| Unpause VM アイコン |

3.3.1. Overview ページ

Overview ページには、リソース、メトリクス、移行の進行状況、およびクラスターレベルの設定が表示されます。

例3.1 Overview ページ

| 要素 | 説明 |

|---|---|

|

virtctl のダウンロード |

リソースを管理するには、 |

| リソース、使用率、アラート、およびステータス。 | |

| CPU、メモリー、およびストレージリソースのトップコンシューマー。 | |

| ライブマイグレーションのステータス。 | |

| Settings タブには、Cluster タブ、User タブ、Preview features タブがあります。 | |

| Settings → Cluster タブ | OpenShift Virtualization のバージョン、更新ステータス、ライブマイグレーション、テンプレートプロジェクト、ロードバランサーサービス、ゲスト管理、リソース管理、SCSI 永続予約の設定。 |

| Settings → User タブ | 公開 SSH キー、ユーザー権限、ウェルカム情報の設定。 |

| Settings → Preview features | Web コンソールで プレビュー機能 を有効にできます。このタブの機能は頻繁に変更されます。 プレビュー機能はデフォルトで無効になっているため、運用環境では有効にしないでください。 |

3.3.1.1. Overview タブ

Overview タブには、リソース、使用率、アラート、およびステータスが表示されます。

例3.2 Overview タブ

| 要素 | 説明 |

|---|---|

| Getting started resources カード |

|

| Memory タイル | 過去 1 日間の傾向を示すグラフを含むメモリー使用率。 |

| Storage タイル | 過去 1 日間の傾向を示すグラフを含むストレージ使用率。 |

| vCPU usage タイル | 過去 1 日間の傾向を示すグラフを含む vCPU 使用率。 |

| VirtualMachines タイル | 過去 1 日間の傾向を示すグラフを含む仮想マシンの数。 |

| Alerts タイル | 重大度別にグループ化された OpenShift Virtualization アラート。 |

| VirtualMachine statuses タイル | ステータスごとにグループ化された仮想マシンの数。 |

| VirtualMachines per resource グラフ | テンプレートとインスタンスタイプから作成された仮想マシンの数。 |

3.3.1.2. Top consumers タブ

Top consumers タブには、CPU、メモリー、およびストレージのトップコンシューマーが表示されます。

例3.3 Top consumers タブ

| 要素 | 説明 |

|---|---|

|

仮想化ダッシュボードを表示 | OpenShift Virtualization のトップコンシューマーを表示する Observe → Dashboards へのリンク。 |

| Time period リスト | 結果をフィルタリングする期間を選択します。 |

| Top consumers リスト | 結果をフィルタリングするトップコンシューマーの数を選択します。 |

| CPU チャート | CPU 使用率が最も高い仮想マシン。 |

| Memory チャート | メモリー使用量が最も多い仮想マシン。 |

| Memory swap traffic チャート | メモリースワップトラフィックが最も多い仮想マシン。 |

| vCPU wait チャート | vCPU 待機時間が最も長い仮想マシン。 |

| Storage throughput チャート | ストレージスループットの使用率が最も高い仮想マシン。 |

| Storage IOPS チャート | 1 秒あたりのストレージ入出力操作の使用率が最も高い仮想マシン。 |

3.3.1.3. Migrations タブ

Migrations タブには、仮想マシンの移行のステータスが表示されます。

例3.4 Migrations タブ

| 要素 | 説明 |

|---|---|

| Time period リスト | 仮想マシンの移行をフィルタリングする期間を選択します。 |

| VirtualMachineInstanceMigrations 情報 テーブル | 仮想マシンの移行のリスト。 |

3.3.1.4. Settings タブ

Settings タブには、クラスター全体の設定が表示されます。

例3.5 Settings タブのタブ

| タブ | 説明 |

|---|---|

| OpenShift Virtualization のバージョン、更新ステータス、ライブマイグレーション、テンプレートプロジェクト、ロードバランサーサービス、ゲスト管理、リソース管理、SCSI 永続予約の設定。 | |

| 公開 SSH キー管理、ユーザー権限、ウェルカム情報設定。 | |

| Web コンソールで プレビュー機能 を有効にできます。これらの機能は頻繁に変更されます。 |

3.3.1.4.1. クラスタータブ

Cluster タブには、OpenShift Virtualization のバージョンと更新ステータスが表示されます。Cluster タブでは、ライブマイグレーションやその他の設定を設定します。

例3.6 Cluster タブ

| 要素 | 説明 |

|---|---|

| インストール済みバージョン | OpenShift Virtualization バージョン |

| 更新ステータス | OpenShift 仮想化の更新ステータス。 |

| Channel | OpenShift 仮想化の更新チャネル。 |

| General Settings セクション | このセクションを展開して、Live migration 設定、SSH configuration 設定、および Template project 設定を設定します。 |

| General Settings → Live Migration セクション | このセクションを展開して、ライブマイグレーション設定を設定します。 |

| General Settings → Live Migration → Max. migrations per cluster フィールド | クラスターごとのライブマイグレーションの最大数を選択します。 |

| General Settings → Live Migration → Max. migrations per node フィールド | ノードごとのライブマイグレーションの最大数を選択します。 |

| General Settings → Live Migration → Live migration network リスト | ライブマイグレーション専用のセカンダリーネットワークを選択します。 |

| General Settings → SSH Configuration → SSH over LoadBalancer service スイッチ | 仮想マシンに対する SSH 接続に使用する LoadBalancer サービスの作成を有効にします。 ロードバランサーを設定する必要があります。 |

| General Settings → SSH Configuration → SSH over NodePort service スイッチ | 仮想マシンへの SSH 接続に使用するノードポートサービスの作成を許可します。 |

| General Settings → Template project セクション |

このセクションを展開して、Red Hat テンプレートのプロジェクトを選択します。デフォルトのプロジェクトは Red Hat テンプレートを複数のプロジェクトに保存するには、テンプレートを複製 し、複製したテンプレートのプロジェクトを選択します。 |

| Guest Management | このセクションを展開して、Automatic subscription of new RHEL VirtualMachines 設定と Enable guest system log access スイッチを設定します。 |

| Guest Management → Automatic subscription of new RHEL VirtualMachines | このセクションを展開して、Red Hat Enterprise Linux (RHEL) 仮想マシンとゲストシステムログアクセスの自動サブスクリプションを有効にします。 この機能を有効にするには、クラスター管理者のパーミッション、組織 ID、およびアクティベーションキーが必要です。 |

| Guest Management → Automatic subscription of new RHEL VirtualMachines → Activation Key フィールド | アクティベーションキーを入力します。 |

| Guest Management → Automatic subscription of new RHEL VirtualMachines → Organization ID フィールド | 組織 ID を入力します。 |

| Guest Management → Automatic subscription of new RHEL VirtualMachines → Enable auto updates for RHEL VirtualMachines スイッチ | RHEL リポジトリーからの更新の自動取得を有効にします。 この機能を有効にするには、アクティベーションキーと組織 ID が必要です。 |

| Guest Management → Enable guest system log access スイッチ | 仮想マシンのゲストシステムログへのアクセスを有効にします。 |

| リソースの管理 | このセクションを展開して、Auto-compute CPU limits 設定と Kernel Samepage Merging (KSM) スイッチを設定します。 |

| Resource Management → Auto-compute CPU limits | ラベルを含むプロジェクトで、自動計算 CPU 制限を有効にします。 |

| Resource Management → Kernel Samepage Merging (KSM) | クラスター内のすべてのノードで KSM を有効にします。 |

| SCSI Persistent Reservation | このセクションを展開して、Enable persistent reservation スイッチを設定します。 |

| SCSI Persistent Reservation → Enable persistent reservation | ディスクの SCSI 予約を有効にします。このオプションは、クラスター対応アプリケーションにのみ使用する必要があります。 |

3.3.1.4.2. ユーザータブ

User タブでは、ユーザー権限を表示し、公開 SSH キーとウェルカム情報を管理します。

例3.7 User タブ

| 要素 | 説明 |

|---|---|

| Manage SSH keys セクション | このセクションを展開して、公開 SSH キーをプロジェクトに追加します。 キーは、選択したプロジェクトでその後作成するすべての仮想マシンに自動的に追加されます。 |

| Permissions セクション | このセクションをデプロイメントすると、クラスター全体のユーザー権限が表示されます。 |

| ようこそ情報 セクション | このセクションを展開すると、Welcome information ダイアログが表示または非表示になります。 |

3.3.1.4.3. プレビュー機能タブ

Web コンソールで プレビュー機能 を有効にできます。このタブの機能は頻繁に変更されます。

3.3.2. Catalog ページ

Catalog ページのテンプレートまたはインスタンスタイプから仮想マシンを作成します。

例3.8 Catalog ページ

| 要素 | 説明 |

|---|---|

| 仮想マシンを作成するための起動可能なボリュームとインスタンスのタイプを表示します。 | |

| 仮想マシンを作成するためのテンプレートのカタログを表示します。 |

3.3.2.1. InstanceTypes タブ

InstanceTypes タブのインスタンスタイプから仮想マシンを作成します。

| 要素 | 説明 |

|---|---|

| Add volume ボタン | クリックしてボリュームをアップロードするか、既存の永続ボリューム要求、ボリュームスナップショット、またはデータソースを使用します。 |

| Volumes project フィールド |

ブート可能なボリュームが保存されているプロジェクト。デフォルトは |

| Filter フィールド | オペレーティングシステムまたはリソースごとにブートソースをフィルタリングします。 |

| Search フィールド | ブートソースを名前で検索します。 |

| Manage columns アイコン | テーブルに表示する列を最大 9 つ選択します。 |

| ボリュームテーブル | 仮想マシンのブート可能ボリュームを選択します。 |

| Red Hat provided タブ | Red Hat が提供するインスタンスタイプを選択します。 |

| User provided タブ | InstanceType ページで作成したインスタンスタイプを選択します。 |

| VirtualMachine details ペイン | 仮想マシンの設定を表示します。 |

| Name フィールド | オプション: 仮想マシン名を入力します。 |

| Storage class フィールド | ストレージクラスを選択します。 |

| 公開 SSH キー | 編集アイコンをクリックして、新規または既存の公開 SSH キーを追加します。 |

| Dynamic SSH key injection スイッチ | 動的 SSH キーの注入を有効にします。 RHEL のみ、動的 SSH キーの注入をサポートしています。 |

| 作成後にこの VirtualMachine を開始する チェックボックス | 仮想マシンが自動的に起動しないようにするには、このチェックボックスをオフにします。 |

| Create VirtualMachine ボタン | 仮想マシンを作成します。 |

| View YAML & CLI ボタン |

YAML 設定ファイルと、コマンドラインから仮想マシンを作成するための |

3.3.2.2. Template catalog タブ

Template catalog タブでテンプレートを選択して、仮想マシンを作成します。

例3.9 Template catalog タブ

| 要素 | 説明 |

|---|---|

| Template project リスト | Red Hat テンプレートが存在するプロジェクトを選択します。

デフォルトでは、Red Hat テンプレートは |

| All items | Default templates | User templates | 使用可能なすべてのテンプレートを表示する場合は All items、デフォルトテンプレートを表示する場合は Default templates、そのユーザーが作成したテンプレートを表示する場合は User templates をクリックします。 |

| Boot source available チェックボックス | チェックボックスをオンにして、使用可能なブートソースを含むテンプレートを表示します。 |

| Operating system チェックボックス | チェックボックスをオンにして、選択したオペレーティングシステムのテンプレートを表示します。 |

| Workload チェックボックス | チェックボックスをオンにして、選択したワークロードを含むテンプレートを表示します。 |

| Search フィールド | テンプレートをキーワードで検索します。 |

| テンプレートタイル | テンプレートタイルをクリックして、テンプレートの詳細を表示し、仮想マシンを作成します。 |

3.3.3. VirtualMachines ページ

VirtualMachines ページで仮想マシンを作成および管理します。

例3.10 VirtualMachines ページ

| 要素 | 説明 |

|---|---|

| Create ボタン | テンプレート、ボリューム、または YAML 設定ファイルから仮想マシンを作成します。 |

| Filter フィールド | ステータス、テンプレート、オペレーティングシステム、またはノードで仮想マシンをフィルタリングします。 |

| Search フィールド | 名前、ラベル、または IP アドレスで仮想マシンを検索します。 |

| Manage columns アイコン | テーブルに表示する列を最大 9 つ選択します。Namespace 列は、Projects リストから All Projects が選択されている場合にのみ表示されます。 |

| 仮想マシンテーブル | 仮想マシンのリスト。

仮想マシンの横にあるアクションメニュー

仮想マシンをクリックして、VirtualMachine details ページに移動します。 |

3.3.3.1. VirtualMachine details ページ

仮想マシンの設定は、VirtualMachine details ページの Configuration タブで行います。

例3.11 VirtualMachine details ページ

| 要素 | 説明 |

|---|---|

| Actions メニュー | Actions メニューをクリックして、Stop、Restart、Pause、Clone、Migrate、Copy SSH command、Edit labels、Edit annotations、または Delete を選択します。Stop を選択すると、、アクションメニューの Force stop が Stop に置き換わります。オペレーティングシステムが応答しなくなった場合は、Force stop を使用して即時シャットダウンを開始します。 |

| リソースの使用率、アラート、ディスク、およびデバイス。 | |

| メモリー、CPU、ストレージ、ネットワーク、移行のメトリクス。 | |

| 仮想マシンの YAML 設定ファイル。 | |

| Details、Storage、Network、Scheduling、SSH、Initial run、および Metadata タブが含まれます。 | |

| 仮想マシンの VirtualMachine details を設定します。 | |

| 仮想マシンのストレージを設定します。 | |

| 仮想マシンのネットワークを設定します。 | |

| 特定のノードで実行される仮想マシンのスケジュールを設定します。 | |

| 仮想マシンの SSH 設定を設定します。 | |

| 仮想マシンの cloud-init を設定するか、仮想マシンが Windows の場合は Sysprep を設定します。 | |

| 仮想マシンのラベルとアノテーションメタデータを設定します。 | |

| 仮想マシンのイベントのリストを表示します。 | |

| 仮想マシンへのコンソールセッションを開きます。 | |

| スナップショットを作成し、そのスナップショットから仮想マシンを復元します。 | |

| ステータス条件とボリュームスナップショットのステータスを表示します。 |

3.3.3.1.1. Overview タブ

Overview タブには、リソースの使用率、アラート、および設定情報が表示されます。

例3.12 Overview タブ

| 要素 | 説明 |

|---|---|

| Details タイル | 一般的な仮想マシン情報。 |

| Utilization タイル | CPU、Memory、Storage、および Network transfer グラフ。デフォルトでは、ネットワーク転送 は、すべてのネットワークの合計を表示します。特定のネットワークの内訳を表示するには、Breakdown by network をクリックします。 |

| Hardware devices タイル | GPU とホストデバイス。 |

| File systems タイル | ファイルシステム情報。 この情報は、ゲストエージェントにより提供されます。 |

| Services タイル | サービスのリスト。 |

| Active users タイル | アクティブなユーザーのリスト。 |

| Alerts タイル | 重大度別にグループ化された OpenShift Virtualization アラート。 |

| General タイル | Namespace、Node、VirtualMachineInstance、Pod、Owner の情報。 |

| Snapshots タイル |

Take snapshot |

| Network interfaces タイル | Network interfaces テーブル。 |

| Disks タイル | Disks テーブル。 |

3.3.3.1.2. Metrics タブ

Metrics タブには、メモリー、CPU、ネットワーク、ストレージ、移行の使用状況グラフと、ライブマイグレーションの進行状況が表示されます。

例3.13 Metrics タブ

| 要素 | 説明 |

|---|---|

| Time range リスト | 結果をフィルタリングする期間を選択します。 |

|

Virtualization ダッシュボード | 現在のプロジェクトの Workloads タブにリンクします。 |

| Utilization | Memory および CPU グラフ。 |

| Storage | Storage total read/write および Storage IOPS total read/write グラフ。 |

| Network | Network in、Network out、Network bandwidth、および Network interface グラフ。Network interface リストから All networks または特定のネットワークを選択します。 |

| Migration | Migration および KV data transfer rate グラフ。 |

| LiveMigration progress | LiveMigration の完了ステータス。 |

3.3.3.1.3. YAML タブ

YAML タブで YAML ファイルを編集して、仮想マシンを設定します。

例3.14 YAML タブ

| 要素 | 説明 |

|---|---|

| Save ボタン | 変更を YAML ファイルに保存します。 |

| Reload ボタン | 変更を破棄し、YAML ファイルをリロードします。 |

| Cancel ボタン | YAML タブを終了します。 |

| Download ボタン | YAML ファイルをローカルマシンにダウンロードします。 |

3.3.3.1.4. Configuration タブ

Configuration タブで、スケジュール、ネットワークインターフェイス、ディスク、およびその他のオプションを設定します。

例3.15 Configuration タブ上のタブ

| 要素 | 説明 |

|---|---|

| Search フィールド | キーワードで設定を検索します。 |

| 仮想マシンの詳細。 | |

| 仮想マシンのストレージを設定します。 | |

| 仮想マシンのネットワークを設定します。 | |

| 特定のノードで実行される仮想マシンのスケジュールを設定します。 | |

| 仮想マシンの SSH 設定を設定します。 | |

| 仮想マシンの cloud-init を設定するか、仮想マシンが Windows の場合は Sysprep を設定します。 | |

| 仮想マシンのラベルとアノテーションメタデータを設定します。 |

3.3.3.1.4.1. Details タブ

Details タブでは、仮想マシンの詳細を管理します。

例3.16 Details タブ

| 設定 | 説明 |

|---|---|

| 説明 | 編集アイコンをクリックして、説明を入力します。 |

| Workload profile | 編集アイコンをクリックして、ワークロードプロファイルを編集します。 |

| CPU | Memory | 編集アイコンをクリックして、CPU | Memory 要求を編集します。仮想マシンを再起動して、変更を適用します。 |

| Hostname | 仮想マシンのホスト名。仮想マシンを再起動して、変更を適用します。 |

| Headless mode | ヘッドレスモードを有効にする。仮想マシンを再起動して、変更を適用します。 |

| Guest system log access | ゲストシステムのログアクセスを有効にします。 |

| Hardware devices | GPU とホストデバイスを管理します。 |

| Boot management | ブートモードと順序を変更し、Start in pause mode を有効にします。 |

3.3.3.1.4.2. ストレージタブ

Storage タブでは、仮想マシンのディスクと環境を管理します。

例3.17 Storage タブ

| 設定 | 説明 |

|---|---|

| Add disk ボタン | 仮想マシンにディスクを追加します。 |

| Filter フィールド | ディスクの種類でフィルタリングします。 |

| Search フィールド | ディスクを名前で検索します。 |

| Mount Windows drivers disk チェックボックス |

VirtIO ドライバーをインストールするために、 |

| Disks テーブル | 仮想マシンのディスクのリスト。

ディスクの横にある actions メニュー

|

| Add Config Map, Secret or Service Account | リンクをクリックして、リソースリストから設定マップ、シークレット、またはサービスアカウントを選択します。 |

3.3.3.1.4.3. Network タブ

Network タブでは、ネットワークインターフェイスを管理します。

例3.18 Network interfaces テーブル。

| 設定 | 説明 |

|---|---|

| Add network interface ボタン | 仮想マシンにネットワークインターフェイスを追加します。 |

| Filter フィールド | インターフェイスタイプでフィルタリングします。 |

| Search フィールド | 名前またはラベルでネットワークインターフェイスを検索します。 |

| Network interface テーブル | ネットワークインターフェイスのリスト。

ネットワークインターフェイスの横にある actions メニュー

|

3.3.3.1.4.4. Scheduling タブ

Scheduling タブで、特定のノードで実行されるように仮想マシンを設定します。

仮想マシンを再起動して変更を適用します。

例3.19 Scheduling タブ

| 設定 | 説明 |

|---|---|

| Node selector | 編集アイコンをクリックして、ラベルを追加し、適格なノードを指定します。 |

| 容認 | 編集アイコンをクリックして、許容範囲を追加し、適格なノードを指定します。 |

| アフィニティールール | 編集アイコンをクリックして、アフィニティールールを追加します。 |

| Descheduler スイッチ | Descheduler を有効または無効にします。Descheduler は、実行中の Pod をエビクトして、Pod をより適切なノードに再スケジュールできるようにします。 仮想マシンをライブマイグレーションできない場合、このフィールドは無効になります。 |

| 専用リソース | 編集アイコンをクリックして、Schedule this workload with dedicated resources (guaranteed policy) を選択します。 |

| エビクションストラテジー | 編集アイコンをクリックして、仮想マシンのエビクション戦略として LiveMigrate を選択します。 |

3.3.3.1.4.5. SSH タブ

SSH タブでは、SSH の詳細を設定します。

例3.20 SSH タブ

| 設定 | 説明 |

|---|---|

| SSH access セクション | このセクションを展開して、SSH using virtctl と SSH service type を設定します。 |

| Public SSH key セクション | このセクションを展開して、公開 SSH キーと動的 SSH 公開キーの注入を設定します。 |

3.3.3.1.4.6. Initial run

Initial run タブでは、cloud-init 設定の管理や、Windows 仮想マシン用の Sysprep の設定を行います。

仮想マシンを再起動して変更を適用します。

例3.21 Initial run タブ

| 要素 | 説明 |

|---|---|

| Cloud-init | 編集アイコンをクリックして、cloud-init 設定を編集します。 |

| Sysprep |

編集アイコンをクリックして |

3.3.3.1.4.7. Metadata タブ

Metadata タブでは、ラベルとアノテーションを設定します。

例3.22 Metadata タブ

| 要素 | 説明 |

|---|---|

| Labels | ラベルを管理するには、編集アイコンをクリックします。 |

| Annotations | アノテーションを管理するには、編集アイコンをクリックします。 |

3.3.3.1.5. Events タブ

Events タブには、仮想マシンイベントのリストが表示されます。

3.3.3.1.6. Console タブ

Console タブで仮想マシンへのコンソールセッションを開くことができます。

例3.23 Console タブ

| 要素 | 説明 |

|---|---|

| Guest login credentials セクション |

Guest login credentials を展開して、 |

| Console リスト | VNC コンソール または Serial コンソール を選択します。 Windows 仮想マシンの場合は、Desktop viewer オプションが表示されます。同じネットワーク上のマシンに RDP クライアントをインストールする必要があります。 |

| Send key リスト | コンソールに送信するキーストロークの組み合わせを選択します。 |

| Paste ボタン | 文字列をクリップボードから VNC コンソールに貼り付けます。 |

| Disconnect ボタン | コンソール接続を切断します。 新しいコンソールセッションを開く場合は、コンソール接続を手動で切断する必要があります。それ以外の場合、最初のコンソールセッションは引き続きバックグラウンドで実行されます。 |

3.3.3.1.7. Snapshots タブ

Snapshots タブでは、スナップショットの作成、スナップショットから仮想マシンのコピーの作成、スナップショットの復元、ラベルまたはアノテーションの編集、ボリュームスナップショットの編集または削除が可能です。

例3.24 Snapshots タブ

| 要素 | 説明 |

|---|---|

| Take snapshot ボタン | スナップショットを作成します。 |

| Filter フィールド | スナップショットをステータスでフィルタリングします。 |

| Search フィールド | 名前またはラベルでスナップショットを検索します。 |

| Snapshot テーブル | スナップショットのリスト。 スナップショット名をクリックして、ラベルまたはアノテーションを編集します。

スナップショットの横にあるアクションメニュー

|

3.3.3.1.8. Diagnostics タブ

Diagnostics タブでステータス条件とボリュームスナップショットのステータスを表示します。

例3.25 Diagnostics タブ

| 要素 | 説明 |

|---|---|

| Status conditions テーブル | 仮想マシンに関して報告された状態のリストを表示します。 |

| Filter フィールド | ステータス条件をカテゴリーと条件でフィルタリングします。 |

| Search フィールド | ステータス条件を理由で検索します。 |

| Manage columns アイコン | テーブルに表示する列を最大 9 つ選択します。 |

| Volume snapshot status テーブル | ボリューム、スナップショットの有効化ステータス、および理由のリスト |

| DataVolume status テーブル | データボリュームとその Phase および Progress の値のリスト。 |

3.3.4. Templates ページ

VirtualMachine Templates ページで仮想マシンテンプレートを作成、編集、およびクローン作成します。

Red Hat テンプレートは編集できません。ただし、Red Hat テンプレートを複製して編集し、カスタムテンプレートを作成できます。

例3.26 VirtualMachine Templates ページ

| 要素 | 説明 |

|---|---|

| Create Template ボタン | YAML 設定ファイルを編集してテンプレートを作成します。 |

| Filter フィールド | テンプレートをタイプ、ブートソース、テンプレートプロバイダー、またはオペレーティングシステムでフィルタリングします。 |

| Search フィールド | 名前またはラベルでテンプレートを検索します。 |

| Manage columns アイコン | テーブルに表示する列を最大 9 つ選択します。Namespace 列は、Projects リストから All Projects が選択されている場合にのみ表示されます。 |

| 仮想マシンテンプレートテーブル | 仮想マシンテンプレートのリスト。

テンプレートの横にある actions メニュー

|

3.3.4.1. テンプレートの詳細ページ

Template details ページで、テンプレートの設定を表示し、カスタムテンプレートを編集します。

例3.27 Template details タブ

| 要素 | 説明 |

|---|---|

| YAML スイッチ | ON を設定して、YAML 設定ファイルでライブの変更を表示します。 |

| Actions メニュー | Actions メニューをクリックして、Edit、Clone、Edit boot source、Edit boot source reference の Edit labels の Edit annotations、または Delete を選択します。 |

| テンプレートの設定と設定。 | |

| YAML 設定ファイル。 | |

| スケジューリング設定。 | |

| ネットワークインターフェイス管理。 | |

| ディスク管理。 | |

| Cloud-init、SSH キー、および Sysprep の管理。 | |

| 名前とクラウドユーザーのパスワード管理。 |

3.3.4.1.1. Details タブ

Details タブでカスタムテンプレートを設定します。

例3.28 Details タブ

| 要素 | 説明 |

|---|---|

| Name | テンプレート名 |

| namespace | テンプレートの namespace。 |

| Labels | 編集アイコンをクリックして、ラベルを編集します。 |

| Annotations | 編集アイコンをクリックして、注釈を編集します。 |

| Display name | 編集アイコンをクリックして、表示名を編集します。 |

| Description | 編集アイコンをクリックして、説明を入力します。 |

| Operating system | オペレーティングシステム名。 |

| CPU|Memory | 編集アイコンをクリックして、CPU|Memory 要求を編集します。

CPU の数は、 |

| Machine type | テンプレートマシンタイプ。 |

| Boot mode | 編集アイコンをクリックして、起動モードを編集します。 |

| Base template | このテンプレートの作成に使用されたベーステンプレートの名前。 |

| Created at | テンプレートの作成日。 |

| 所有者 | テンプレート所有者。 |

| Boot order | テンプレートの起動順序。 |

| Boot source | ブートソースの可用性。 |

| プロバイダー | テンプレートプロバイダー |

| Support | テンプレートのサポートレベル。 |

| GPU devices | 編集アイコンをクリックして、GPU デバイスを追加します。 |

| Host devices | 編集アイコンをクリックして、ホストデバイスを追加します。 |

| Headless mode | 編集アイコンをクリックしてヘッドレスモードを ON に設定し、VNC コンソールを無効にします。 |

3.3.4.1.2. YAML タブ

YAML タブで YAML ファイルを編集して、カスタムテンプレートを設定します。

例3.29 YAML タブ

| 要素 | 説明 |

|---|---|

| Save ボタン | 変更を YAML ファイルに保存します。 |

| Reload ボタン | 変更を破棄し、YAML ファイルをリロードします。 |

| Cancel ボタン | YAML タブを終了します。 |

| Download ボタン | YAML ファイルをローカルマシンにダウンロードします。 |

3.3.4.1.3. Scheduling タブ

Scheduling タブでスケジュールを設定します。

例3.30 Scheduling タブ

| 設定 | 説明 |

|---|---|

| Node selector | 編集アイコンをクリックして、ラベルを追加し、適格なノードを指定します。 |

| 容認 | 編集アイコンをクリックして、許容範囲を追加し、適格なノードを指定します。 |

| アフィニティールール | 編集アイコンをクリックして、アフィニティールールを追加します。 |

| Descheduler スイッチ | Descheduler を有効または無効にします。Descheduler は、実行中の Pod をエビクトして、Pod をより適切なノードに再スケジュールできるようにします。 |

| 専用リソース | 編集アイコンをクリックして、Schedule this workload with dedicated resources (guaranteed policy) を選択します。 |

| エビクションストラテジー | 編集アイコンをクリックして、仮想マシンのエビクション戦略として LiveMigrate を選択します。 |

3.3.4.1.4. Network interfaces タブ

Network interfaces タブでネットワークインターフェイスを管理します。

例3.31 Network interfaces タブ

| 設定 | 説明 |

|---|---|

| Add network interface ボタン | テンプレートにネットワークインターフェイスを追加します。 |

| Filter フィールド | インターフェイスタイプでフィルタリングします。 |

| Search フィールド | 名前またはラベルでネットワークインターフェイスを検索します。 |

| Network interface テーブル | ネットワークインターフェイスのリスト。

ネットワークインターフェイスの横にある actions メニュー

|

3.3.4.1.5. Disks タブ

ディスクは、Disks タブで管理します。

例3.32 Disks タブ

| 設定 | 説明 |

|---|---|

| Add disk ボタン | テンプレートにディスクを追加します。 |

| Filter フィールド | ディスクの種類でフィルタリングします。 |

| Search フィールド | ディスクを名前で検索します。 |

| Disks テーブル | テンプレートディスクのリスト。

ディスクの横にある actions メニュー

|

3.3.4.1.6. Scripts タブ

Scripts タブで、cloud-init 設定、SSH キー、および Sysprep 応答ファイルを管理します。

例3.33 Scripts タブ

| 要素 | 説明 |

|---|---|

| Cloud-init | 編集アイコンをクリックして、cloud-init 設定を編集します。 |

| 公開 SSH キー | 編集アイコンをクリックして、新しいシークレットを作成するか、既存のシークレットを Linux 仮想マシンに割り当てます。 |

| Sysprep |

編集アイコンをクリックして |

3.3.4.1.7. パラメータータブ

パラメーター タブで、選択したテンプレート設定を編集します。

例3.34 Parameters タブ

| 要素 | 説明 |

|---|---|

| 名前 | このテンプレートから作成された仮想マシンの名前パラメーターを設定します。 |

| CLOUD_USER_PASSWORD | このテンプレートから作成された仮想マシンのクラウドユーザーパスワードパラメーターを設定します。 |

3.3.5. InstanceTypes ページ

InstanceTypes ページで仮想マシンインスタンスタイプを表示および管理します。

例3.35 VirtualMachineClusterInstancetypes ページ

| 要素 | 説明 |

|---|---|

| Create ボタン | YAML 設定ファイルを編集して、インスタンスタイプを作成します。 |

| Search フィールド | インスタンスタイプを名前またはラベルで検索します。 |

| Manage columns アイコン | テーブルに表示する列を最大 9 つ選択します。Namespace 列は、Projects リストから All Projects が選択されている場合にのみ表示されます。 |

| Instance types テーブル | インスタンスのリスト。

インスタンスタイプの横にあるアクションメニュー

|

インスタンスタイプをクリックして、VirtualMachineClusterInstancetypes details ページを表示します。

3.3.5.1. VirtualMachineClusterInstancetypes details ページ

VirtualMachineClusterInstancetypes details ページでインスタンスタイプを設定します。

例3.36 VirtualMachineClusterInstancetypes details ページ

| 要素 | 説明 |

|---|---|

| Details タブ | フォームを編集してインスタンスタイプを設定します。 |

| YAML タブ | YAML 設定ファイルを編集して、インスタンスタイプを設定します。 |

| Actions メニュー | Edit labels、Edit annotations、Edit VirtualMachineClusterInstancetype、または Delete VirtualMachineClusterInstancetype を選択します。 |

3.3.5.1.1. Details タブ

インスタンスタイプを設定するには、Details タブでフォームを編集します。

例3.37 Details タブ

| 要素 | 説明 |

|---|---|

| Name | VirtualMachineClusterInstancetype の名前。 |

| Labels | 編集アイコンをクリックして、ラベルを編集します。 |

| Annotations | 編集アイコンをクリックして、注釈を編集します。 |

| Created at | インスタンスタイプの作成日。 |

| 所有者 | インスタンスタイプの所有者。 |

3.3.5.1.2. YAML タブ

インスタンスタイプを設定するには、YAML タブで YAML ファイルを編集します。

例3.38 YAML タブ

| 要素 | 説明 |

|---|---|

| Save ボタン | 変更を YAML ファイルに保存します。 |

| Reload ボタン | 変更を破棄し、YAML ファイルをリロードします。 |

| Cancel ボタン | YAML タブを終了します。 |

| Download ボタン | YAML ファイルをローカルマシンにダウンロードします。 |

3.3.6. Preferences ページ

Preferences ページで仮想マシンの設定を表示および管理します。

例3.39 VirtualMachineClusterPreferences ページ

| 要素 | 説明 |

|---|---|

| Create ボタン | YAML 設定ファイルを編集して設定を作成します。 |

| Search フィールド | 名前またはラベルで設定を検索します。 |

| Manage columns アイコン | テーブルに表示する列を最大 9 つ選択します。Namespace 列は、Projects リストから All Projects が選択されている場合にのみ表示されます。 |

| Preferences テーブル | 設定のリスト。

設定の横にあるアクションメニュー

|

設定をクリックして、VirtualMachineClusterPreference details ページを表示します。

3.3.6.1. VirtualMachineClusterPreference details ページ

VirtualMachineClusterPreference details ページで設定を指定します。

例3.40 VirtualMachineClusterPreference details ページ

| 要素 | 説明 |

|---|---|

| Details タブ | フォームを編集して設定を指定します。 |

| YAML タブ | YAML 設定ファイルを編集して設定を指定します。 |

| Actions メニュー | Edit labels、Edit annotations、Edit VirtualMachineClusterPreference、または Delete VirtualMachineClusterPreference を選択します。 |

3.3.6.1.1. Details タブ

Details タブでフォームを編集して設定を指定します。

例3.41 Details タブ

| 要素 | 説明 |

|---|---|

| Name | VirtualMachineClusterPreference の名前。 |

| Labels | 編集アイコンをクリックして、ラベルを編集します。 |

| Annotations | 編集アイコンをクリックして、注釈を編集します。 |

| Created at | 設定の作成日。 |

| 所有者 | 設定の所有者。 |

3.3.6.1.2. YAML タブ

設定タイプを設定するには、YAML タブで YAML ファイルを編集します。

例3.42 YAML タブ

| 要素 | 説明 |

|---|---|

| Save ボタン | 変更を YAML ファイルに保存します。 |

| Reload ボタン | 変更を破棄し、YAML ファイルをリロードします。 |

| Cancel ボタン | YAML タブを終了します。 |

| Download ボタン | YAML ファイルをローカルマシンにダウンロードします。 |

3.3.7. Bootable volumes ページ

Bootable volumes ページで、使用可能なブート可能ボリュームを表示および管理します。

例3.43 Bootable volumes ページ

| 要素 | 説明 |

|---|---|

| Add volume ボタン | フォームに入力するか、YAML 設定ファイルを編集して、ブート可能ボリュームを追加します。 |

| Filter フィールド | ブート可能ボリュームをオペレーティングシステムとリソースタイプでフィルタリングします。 |

| Search フィールド | ブート可能ボリュームを名前またはラベルで検索します。 |

| Manage columns アイコン | テーブルに表示する列を最大 9 つ選択します。Namespace 列は、Projects リストから All Projects が選択されている場合にのみ表示されます。 |

| ブート可能ボリュームテーブル | ブート可能なボリュームのリスト。

ブート可能ボリュームの横にあるアクションメニュー

|

ブート可能ボリュームをクリックして、DataSource details ページを表示します。

3.3.7.1. DataSource details ページ

DataSource details ページでは、ブート可能ボリュームの永続ボリューム要求 (PVC) を設定します。

例3.44 DataSource details ページ

| 要素 | 説明 |

|---|---|

| Details タブ | フォームを編集して PVC を設定します。 |

| YAML タブ | YAML 設定ファイルを編集して PVC を設定します。 |

3.3.7.1.1. Details タブ

Details タブのフォームを編集して、ブート可能ボリュームの永続ボリューム要求 (PVC) を設定します。

例3.45 Details タブ

| 要素 | 説明 |

|---|---|

| Name | データソース名。 |

| namespace | データソースの namespace。 |

| Labels | 編集アイコンをクリックして、ラベルを編集します。 |

| Annotations | 編集アイコンをクリックして、注釈を編集します。 |

| Created at | データソースの作成日。 |

| 所有者 | データソースの所有者。 |

| DataImportCron |

データソースの |

| Default Instance Type | このデータソースのデフォルトのインスタンス型。 |

| Preference |

特定のワークロードを実行するために必要な、優先される |

| 条件 表 | データソースの型、ステータス、最終更新、理由、メッセージが表示されます。 |

3.3.7.1.2. YAML タブ

ブート可能ボリュームの永続ボリューム要求を設定するには、YAML タブで YAML ファイルを編集します。

例3.46 YAML タブ

| 要素 | 説明 |

|---|---|

| Save ボタン | 変更を YAML ファイルに保存します。 |

| Reload ボタン | 変更を破棄し、YAML ファイルをリロードします。 |

| Cancel ボタン | YAML タブを終了します。 |

| Download ボタン | YAML ファイルをローカルマシンにダウンロードします。 |

3.3.8. MigrationPolicies ページ

MigrationPolicies ページでワークロードの移行ポリシーを管理します。

例3.47 MigrationPolicies ページ

| 要素 | 説明 |

|---|---|

| MigrationPolicy の作成 | フォームに設定とラベルを入力するか、YAML ファイルを編集して、移行ポリシーを作成します。 |

| Search フィールド | 名前またはラベルで移行ポリシーを検索します。 |

| Manage columns アイコン | テーブルに表示する列を最大 9 つ選択します。Namespace 列は、Projects リストから All Projects が選択されている場合にのみ表示されます。 |

| MigrationPolicies テーブル | 移行ポリシーのリスト。

移行ポリシーの横にあるアクションメニュー

|

移行ポリシーをクリックして、MigrationPolicy details ページを表示します。

3.3.8.1. MigrationPolicy details ページ

移行ポリシーは、MigrationPolicy details ページで設定します。

例3.48 MigrationPolicy details ページ

| 要素 | 説明 |

|---|---|

| Details タブ | フォームを編集して移行ポリシーを設定します。 |

| YAML タブ | YAML 設定ファイルを編集して、移行ポリシーを設定します。 |

| Actions メニュー | Edit または Delete を選択します。 |

3.3.8.1.1. Details タブ

Details タブでカスタムテンプレートを設定します。

例3.49 Details タブ

| 要素 | 説明 |

|---|---|

| Name | 移行ポリシー名。 |

| Description | 移行ポリシーの説明。 |

| 設定 | 編集アイコンをクリックして、移行ポリシー設定を更新します。 |

| 移行ごとの帯域幅 |

移行ごとの帯域幅要求。帯域幅を無制限にするには、値を |

| 自動収束 | 自動収束が有効になっている場合は、移行を確実に成功させるために、仮想マシンのパフォーマンスと可用性が低下する可能性があります。 |

| ポストコピー | ポストコピーポリシー。 |

| 完了タイムアウト | 秒単位の完了タイムアウト値。 |

| プロジェクトラベル | Edit をクリックして、プロジェクトラベルを編集します。 |

| VirtualMachine のラベル | Edit をクリックして仮想マシンのラベルを編集します。 |

3.3.8.1.2. YAML タブ

移行ポリシーを設定するには、YAML タブで YAML ファイルを編集します。

例3.50 YAML タブ

| 要素 | 説明 |

|---|---|

| Save ボタン | 変更を YAML ファイルに保存します。 |

| Reload ボタン | 変更を破棄し、YAML ファイルをリロードします。 |

| Cancel ボタン | YAML タブを終了します。 |

| Download ボタン | YAML ファイルをローカルマシンにダウンロードします。 |

3.3.9. Checkups ページ

Checkups ページでは、仮想マシンのネットワーク遅延とストレージのチェックを実行します。

例3.51 Checkups ページ

| 要素 | 説明 |

|---|---|

| Network latency タブ | ネットワーク遅延チェックを実行します。 |

| Storage タブ | ストレージチェックを実行します。 |

第4章 インストール

4.1. OpenShift Virtualization のクラスターの準備

OpenShift Virtualization をインストールする前にこのセクションを確認して、クラスターが要件を満たしていることを確認してください。

- インストール方法の考慮事項

- ユーザープロビジョニング、インストーラープロビジョニング、またはアシステッドインストーラーなど、任意のインストール方法を使用して、OpenShift Container Platform をデプロイできます。ただし、インストール方法とクラスタートポロジーは、スナップショットや ライブマイグレーション などの OpenShift Virtualization 機能に影響を与える可能性があります。

- Red Hat OpenShift Data Foundation

- Red Hat OpenShift Data Foundation を使用して OpenShift Virtualization をデプロイする場合は、Windows 仮想マシンディスク用の専用ストレージクラスを作成する必要があります。詳細は Optimizing ODF PersistentVolumes for Windows VMs を参照してください。

- IPv6

- シングルスタックの IPv6 クラスターで OpenShift Virtualization は実行できません。

FIPS モード

クラスターを FIPS モード でインストールする場合、OpenShift Virtualization に追加の設定は必要ありません。

4.1.1. サポート対象のプラットフォーム

OpenShift Virtualization では、以下のプラットフォームを使用できます。

- オンプレミスのベアメタルサーバー。OpenShift Virtualization のベアメタルクラスターの計画 を 参照してください。

IBM Cloud® ベアメタルサーバー。Deploy OpenShift Virtualization on IBM Cloud® Bare Metal nodes を参照してください。

重要IBM Cloud® ベアメタルサーバーへの OpenShift Virtualization のインストールは、テクノロジープレビュー機能としてのみ提供されます。テクノロジープレビュー機能は、Red Hat 製品のサービスレベルアグリーメント (SLA) の対象外であり、機能的に完全ではないことがあります。Red Hat は、実稼働環境でこれらを使用することを推奨していません。テクノロジープレビュー機能は、最新の製品機能をいち早く提供して、開発段階で機能のテストを行い、フィードバックを提供していただくことを目的としています。

Red Hat のテクノロジープレビュー機能のサポート範囲に関する詳細は、テクノロジープレビュー機能のサポート範囲 を参照してください。

他のクラウドプロバイダーが提供するベアメタルインスタンスまたはサーバーはサポートされていません。

4.1.1.1. AWS ベアメタル上の OpenShift Virtualization

OpenShift Virtualization は、Amazon Web Services (AWS) ベアメタル OpenShift Container Platform クラスターで実行できます。

OpenShift Virtualization は、AWS ベアメタルクラスターと同じ設定要件を持つ Red Hat OpenShift Service on AWS (ROSA) Classic クラスターでもサポートされています。

クラスターを設定する前に、サポート対象の機能と制限に関する以下の要約を確認してください。

- インストール

installer-provisioned infrastructure を使用してクラスターをインストールできます。その際に、

install-config.yamlファイルを編集してワーカーノードのベアメタルインスタンスタイプを確実に指定してください。たとえば、x86_64 アーキテクチャーをベースとするマシンのc5n.metalタイプの値を使用できます。詳細は、AWS へのインストールに関する OpenShift Container Platform ドキュメントを参照してください。

- 仮想マシン (VM) へのアクセス

-

virtctlCLI ツールまたは OpenShift Container Platform Web コンソールを使用して仮想マシンにアクセスする方法に変更はありません。 NodePortまたはLoadBalancerサービスを使用して、仮想マシンを公開できます。- OpenShift Container Platform は AWS でロードバランサーを自動的に作成し、そのライフサイクルを管理するため、ロードバランサーのアプローチが推奨されます。また、セキュリティーグループはロードバランサー用にも作成され、アノテーションを使用して既存のセキュリティーグループをアタッチできます。サービスを削除すると、OpenShift Container Platform はロードバランサーとそれに関連付けられたリソースを削除します。

- ネットワーク

- Single Root I/O Virtualization (SR-IOV) またはブリッジ Container Network Interface (CNI) ネットワーク (仮想 LAN (VLAN) を含む) は使用できません。アプリケーションにフラットレイヤー 2 ネットワークが必要な場合や、IP プールを制御する必要がある場合は、OVN-Kubernetes セカンダリーオーバーレイネットワークを使用することを検討してください。

- ストレージ

基盤となるプラットフォームとの連携がストレージベンダーによって認定されている任意のストレージソリューションを使用できます。

重要AWS ベアメタルクラスターと ROSA クラスターでは、サポートされているストレージソリューションが異なる場合があります。ストレージベンダーにサポートを確認してください。

- OpenShift Virtualization で Amazon Elastic File System (EFS) または Amazon Elastic Block Store (EBS) を使用すると、パフォーマンスと機能が制限される可能性があります。ライブマイグレーション、高速仮想マシンの作成、仮想マシンスナップショット機能の有効化を行うには、ReadWriteMany (RWX)、クローン作成、スナップショットをサポートする CSI ストレージの使用を検討してください。

- Hosted Control Plane (HCP)

- OpenShift Virtualization の HCP は現在、AWS インフラストラクチャーではサポートされていません。

4.1.2. ハードウェアとオペレーティングシステムの要件

OpenShift Virtualization の次のハードウェアおよびオペレーティングシステム要件を確認してください。

4.1.2.1. CPU の要件

Red Hat Enterprise Linux (RHEL) 9 でサポート。

サポートされている CPU の Red Hat Ecosystem Catalog を参照してください。

注記ワーカーノードの CPU が異なる場合は、CPU ごとに機能が異なるため、ライブマイグレーションが失敗する可能性があります。この問題は、ワーカーノードに適切な容量の CPU が搭載されていることを確認し、仮想マシンのノードアフィニティールールを設定することで軽減できます。

詳細は、ノードアフィニティーの required (必須) ルールの設定 を参照してください。

- AMD および Intel 64 ビットアーキテクチャー (x86-64-v2) のサポート。

- Intel 64 または AMD64 CPU 拡張機能のサポート。

- Intel VT または AMD-V ハードウェア仮想化拡張機能が有効化されている。

- NX (実行なし) フラグが有効。

4.1.2.2. オペレーティングシステム要件

ワーカーノードにインストールされた Red Hat Enterprise Linux CoreOS (RHCOS)。

詳細は、RHCOS について を参照してください。

注記RHEL ワーカーノードはサポートされていません。

4.1.2.3. ストレージ要件

- OpenShift Container Platform によるサポート。ストレージの最適化 を 参照してください。

- デフォルトの OpenShift Virtualization または OpenShift Container Platform ストレージクラスを作成する必要があります。これは、仮想マシンワークロード固有のストレージニーズに対応し、最適化されたパフォーマンス、信頼性、ユーザーエクスペリエンスを提供することを目的としています。OpenShift Virtualization と OpenShift Container Platform の両方にデフォルトのストレージクラスが存在する場合、仮想マシンディスクの作成時には OpenShift Virtualization のクラスが優先されます。

ストレージクラスを仮想化ワークロードのデフォルトとしてマークするには、アノテーション storageclass.kubevirt.io/is-default-virt-class を "true" に設定します。

-

ストレージプロビジョナーがスナップショットをサポートしている場合は、

VolumeSnapshotClassオブジェクトをデフォルトのストレージクラスに関連付ける必要があります。

4.1.2.3.1. 仮想マシンディスクのボリュームとアクセスモードについて

既知のストレージプロバイダーでストレージ API を使用する場合、ボリュームモードとアクセスモードは自動的に選択されます。ただし、ストレージプロファイルのないストレージクラスを使用する場合は、ボリュームとアクセスモードを設定する必要があります。

OpenShift Virtualization の既知のストレージプロバイダーのリストは、Red Hat Ecosystem Catalog を 参照してください。

最良の結果を得るには、ReadWriteMany (RWX) アクセスモードと Block ボリュームモードを使用してください。これは、以下の理由により重要です。

-

ライブマイグレーションには

ReadWriteMany(RWX) アクセスモードが必要です。 Blockボリュームモードは、Filesystemボリュームモードよりもパフォーマンスが大幅に優れています。これは、Filesystemボリュームモードでは、ファイルシステムレイヤーやディスクイメージファイルなどを含め、より多くのストレージレイヤーが使用されるためです。仮想マシンのディスクストレージに、これらのレイヤーは必要ありません。たとえば、Red Hat OpenShift Data Foundation を使用する場合は、CephFS ボリュームよりも Ceph RBD ボリュームの方が推奨されます。

次の設定の仮想マシンをライブマイグレーションすることはできません。

-

ReadWriteOnce(RWO) アクセスモードのストレージボリューム - GPU などのパススルー機能

これらの仮想マシンの evictionStrategy フィールドを None に設定します。None ストラテジーでは、ノードの再起動中に仮想マシンの電源がオフになります。

4.1.3. ライブマイグレーションの要件

-

ReadWriteMany(RWX) アクセスモードの共有ストレージ 十分な RAM およびネットワーク帯域幅

注記ノードのドレインに伴うライブマイグレーションを実行できるように、クラスター内に十分なメモリーリクエスト容量があることを確認する必要があります。以下の計算を使用して、必要な予備のメモリーを把握できます。

Product of (Maximum number of nodes that can drain in parallel) and (Highest total VM memory request allocations across nodes)クラスターで 並行して実行できるデフォルトの移行数 は 5 です。

- 仮想マシンがホストモデルの CPU を使用する場合、ノードは仮想マシンのホストモデルの CPU をサポートする必要があります。

- ライブマイグレーション 専用の Multus ネットワーク を強く推奨します。専用ネットワークは、移行中のテナントワークロードに対するネットワークの飽和状態の影響を最小限に抑えます。

4.1.4. 物理リソースのオーバーヘッド要件

OpenShift Virtualization は OpenShift Container Platform のアドオンであり、クラスターの計画時に考慮する必要のある追加のオーバーヘッドを強要します。各クラスターマシンは、OpenShift Container Platform の要件に加えて、以下のオーバーヘッドの要件を満たす必要があります。クラスター内の物理リソースを過剰にサブスクライブすると、パフォーマンスに影響する可能性があります。

このドキュメントに記載されている数は、Red Hat のテスト方法およびセットアップに基づいています。これらの数は、独自のセットアップおよび環境に応じて異なります。

メモリーのオーバーヘッド

以下の式を使用して、OpenShift Virtualization のメモリーオーバーヘッドの値を計算します。

クラスターメモリーのオーバーヘッド

Memory overhead per infrastructure node ≈ 150 MiBMemory overhead per worker node ≈ 360 MiBさらに、OpenShift Virtualization 環境リソースには、すべてのインフラストラクチャーノードに分散される合計 2179 MiB の RAM が必要です。

仮想マシンのメモリーオーバーヘッド

Memory overhead per virtual machine ≈ (1.002 × requested memory) \

+ 218 MiB \

+ 8 MiB × (number of vCPUs) \

+ 16 MiB × (number of graphics devices) \

+ (additional memory overhead) - 1

virt-launcherPod で実行されるプロセスに必要です。- 2

- 仮想マシンが要求する仮想 CPU の数。

- 3

- 仮想マシンが要求する仮想グラフィックスカードの数。

- 4

- 追加のメモリーオーバーヘッド:

- お使いの環境に Single Root I/O Virtualization (SR-IOV) ネットワークデバイスまたは Graphics Processing Unit (GPU) が含まれる場合、それぞれのデバイスに 1 GiB の追加のメモリーオーバーヘッドを割り当てます。

- Secure Encrypted Virtualization (SEV) が有効な場合は、256 MiB を追加します。

- Trusted Platform Module (TPM) が有効な場合は、53 MiB を追加します。

CPU オーバーヘッド

以下の式を使用して、OpenShift Virtualization のクラスタープロセッサーのオーバーヘッド要件を計算します。仮想マシンごとの CPU オーバーヘッドは、個々の設定によって異なります。

クラスターの CPU オーバーヘッド

CPU overhead for infrastructure nodes ≈ 4 coresOpenShift Virtualization は、ロギング、ルーティング、およびモニタリングなどのクラスターレベルのサービスの全体的な使用率を増加させます。このワークロードに対応するには、インフラストラクチャーコンポーネントをホストするノードに、4 つの追加コア (4000 ミリコア) の容量があり、これがそれらのノード間に分散されていることを確認します。

CPU overhead for worker nodes ≈ 2 cores + CPU overhead per virtual machine仮想マシンをホストする各ワーカーノードには、仮想マシンのワークロードに必要な CPU に加えて、OpenShift Virtualization 管理ワークロード用に 2 つの追加コア (2000 ミリコア) の容量が必要です。

仮想マシンの CPU オーバーヘッド

専用の CPU が要求される場合は、仮想マシン 1 台につき CPU 1 つとなり、クラスターの CPU オーバーヘッド要件に影響が出てきます。それ以外の場合は、仮想マシンに必要な CPU の数に関する特別なルールはありません。

ストレージのオーバーヘッド

以下のガイドラインを使用して、OpenShift Virtualization 環境のストレージオーバーヘッド要件を見積もります。

クラスターストレージオーバーヘッド

Aggregated storage overhead per node ≈ 10 GiB10 GiB は、OpenShift Virtualization のインストール時にクラスター内の各ノードに関するディスク上のストレージの予想される影響に相当します。

仮想マシンのストレージオーバーヘッド

仮想マシンごとのストレージオーバーヘッドは、仮想マシン内のリソース割り当ての特定の要求により異なります。この要求は、クラスター内の別の場所でホストされるノードまたはストレージリソースの一時ストレージに対するものである可能性があります。OpenShift Virtualization は現在、実行中のコンテナー自体に追加の一時ストレージを割り当てていません。

例

クラスター管理者が、クラスター内の 10 台の (それぞれ 1 GiB の RAM と 2 つの仮想 CPU の) 仮想マシンをホストする予定の場合、クラスター全体で影響を受けるメモリーは 11.68 GiB になります。クラスターの各ノードについて予想されるディスク上のストレージの影響は 10 GiB で示され、仮想マシンのワークロードをホストするワーカーノードに関する CPU の影響は最小 2 コアで示されます。

4.1.5. シングルノード OpenShift の違い

OpenShift Virtualization はシングルノード OpenShift にインストールできます。

ただし、シングルノード OpenShift は次の機能をサポートしていないことに注意してください。

- 高可用性

- Pod の中断

- ライブマイグレーション

- エビクションストラテジーが設定されている仮想マシンまたはテンプレート

4.1.6. オブジェクトの最大値

クラスターを計画するときは、次のテスト済みオブジェクトの最大数を考慮する必要があります。

4.1.7. クラスターの高可用性オプション

クラスターには、次の高可用性 (HA) オプションのいずれかを設定できます。

インストーラーによってプロビジョニングされたインフラストラクチャー (IPI)の 自動高可用性は、マシンヘルスチェック をデプロイすることで利用できます。

注記インストーラーによってプロビジョニングされたインフラストラクチャーを使用し、適切に設定された

MachineHealthCheckリソースを使用してインストールされた OpenShift Container Platform クラスターでは、ノードがマシンヘルスチェックに失敗し、クラスターで使用できなくなった場合、そのノードはリサイクルされます。障害が発生したノードで実行された仮想マシンでは、一連の条件によって次に起こる動作が変わります。潜在的な結果と実行ストラテジーがその結果にどのように影響するかについての詳細は、実行ストラテジー を参照してください。-

IPI と非 IPI の両方の自動高可用性は、OpenShift Container Platform クラスターで Node Health Check Operator を使用して

NodeHealthCheckコントローラーをデプロイすることで利用できます。コントローラーは異常なノードを特定し、Self Node Remediation Operator や Fence Agents Remediation Operator などの修復プロバイダーを使用して異常なノードを修復します。ノードの修復、フェンシング、メンテナンスの詳細は、Red Hat OpenShift のワークロードの可用性 を参照してください。 モニタリングシステムまたは有資格者を使用してノードの可用性をモニターすることにより、あらゆるプラットフォームの高可用性を利用できます。ノードが失われた場合は、これをシャットダウンして

oc delete node <lost_node>を実行します。注記外部モニタリングシステムまたは資格のある人材によるノードの正常性の監視が行われない場合、仮想マシンは高可用性を失います。

4.2. OpenShift Virtualization のインストール

OpenShift Virtualization をインストールし、仮想化機能を OpenShift Container Platform クラスターに追加します。

インターネット接続のない制限された環境に OpenShift Virtualization をインストールする場合は、制限されたネットワーク用に Operator Lifecycle Manager (OLM)を設定 する必要があります。

インターネット接続が制限されている場合は、OLM でプロキシーサポートを設定 して OperatorHub にアクセスできます。

4.2.1. OpenShift Virtualization Operator のインストール

OpenShift Container Platform Web コンソールまたはコマンドラインを使用して、OpenShift Virtualization Operator をインストールします。

4.2.1.1. Web コンソールを使用した OpenShift Virtualization Operator のインストール

OpenShift Container Platform Web コンソールを使用して、OpenShift Virtualization Operator をデプロイできます。

前提条件

- OpenShift Container Platform 4.15 をクラスターにインストールしている。

-

cluster-adminパーミッションを持つユーザーとして OpenShift Container Platform Web コンソールにログインしている。

手順

- Administrator パースペクティブから、Operators → OperatorHub をクリックします。

- Filter by keyword に Virtualization と入力します。

- Red Hat ソースラベルが示されている OpenShift Virtualization Operator タイルを選択します。

- Operator の情報を確認してから、Install をクリックします。

Install Operator ページで以下を行います。

- 選択可能な Update Channel オプションの一覧から stable を選択します。これにより、OpenShift Container Platform バージョンと互換性がある OpenShift Virtualization のバージョンをインストールすることができます。

インストールされた namespace の場合、Operator recommended namespace オプションが選択されていることを確認します。これにより、Operator が必須の

openshift-cnvnamespace にインストールされます。この namespace は存在しない場合は、自動的に作成されます。警告OpenShift Virtualization Operator を

openshift-cnv以外の namespace にインストールしようとすると、インストールが失敗します。Approval Strategy の場合に、stable 更新チャネルで新しいバージョンが利用可能になったときに OpenShift Virtualization が自動更新されるように、デフォルト値である Automatic を選択することを強く推奨します。

Manual 承認ストラテジーを選択することは可能ですが、クラスターのサポート容易性および機能に対応するリスクが高いため、推奨できません。これらのリスクを完全に理解していて、Automatic を使用できない場合のみ、Manual を選択してください。

警告OpenShift Virtualization は対応する OpenShift Container Platform バージョンで使用される場合にのみサポートされるため、OpenShift Virtualization が更新されないと、クラスターがサポートされなくなる可能性があります。

-

Install をクリックし、Operator を

openshift-cnvnamespace で利用可能にします。 - Operator が正常にインストールされたら、Create HyperConverged をクリックします。

- オプション: OpenShift Virtualization コンポーネントの Infra および Workloads ノード配置オプションを設定します。

- Create をクリックして OpenShift Virtualization を起動します。

検証

- Workloads → Pods ページに移動して、OpenShift Virtualization Pod がすべて Running 状態になるまでこれらの Pod をモニターします。すべての Pod で Running 状態が表示された後に、OpenShift Virtualization を使用できます。

4.2.1.2. コマンドラインを使用した OpenShift Virtualization Operator のインストール

OpenShift Virtualization カタログをサブスクライブし、クラスターにマニフェストを適用して OpenShift Virtualization Operator をインストールします。

4.2.1.2.1. CLI を使用した OpenShift Virtualization カタログのサブスクライブ

OpenShift Virtualization をインストールする前に、OpenShift Virtualization カタログにサブスクライブする必要があります。サブスクライブにより、openshift-cnv namespace に OpenShift Virtualization Operator へのアクセスが付与されます。

単一マニフェストをクラスターに適用して Namespace、OperatorGroup、および Subscription オブジェクトをサブスクライブし、設定します。

前提条件

- OpenShift Container Platform 4.15 をクラスターにインストールしている。

-

OpenShift CLI (

oc) がインストールされている。 -

cluster-admin権限を持つユーザーとしてログインしている。

手順

以下のマニフェストを含む YAML ファイルを作成します。

apiVersion: v1 kind: Namespace metadata: name: openshift-cnv labels: openshift.io/cluster-monitoring: "true" --- apiVersion: operators.coreos.com/v1 kind: OperatorGroup metadata: name: kubevirt-hyperconverged-group namespace: openshift-cnv spec: targetNamespaces: - openshift-cnv --- apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: hco-operatorhub namespace: openshift-cnv spec: source: redhat-operators sourceNamespace: openshift-marketplace name: kubevirt-hyperconverged startingCSV: kubevirt-hyperconverged-operator.v4.15.10 channel: "stable"1 - 1

stableチャネルを使用することで、OpenShift Container Platform バージョンと互換性のある OpenShift Virtualization のバージョンをインストールすることができます。

以下のコマンドを実行して、OpenShift Virtualization に必要な

Namespace、OperatorGroup、およびSubscriptionオブジェクトを作成します。$ oc apply -f <file name>.yaml

YAML ファイルで、証明書のローテーションパラメーターを設定 できます。

4.2.1.2.2. CLI を使用した OpenShift Virtualization Operator のデプロイ

oc CLI を使用して OpenShift Virtualization Operator をデプロイすることができます。

前提条件

-

openshift-cnvnamespace の OpenShift Virtualization カタログへのサブスクリプション。 -

cluster-admin権限を持つユーザーとしてログインしている。

手順

以下のマニフェストを含む YAML ファイルを作成します。