보안 및 컴플라이언스

OpenShift Container Platform의 보안 학습 및 관리

초록

1장. OpenShift Container Platform 보안 및 컴플라이언스

1.1. 보안 개요

OpenShift Container Platform 클러스터의 다양한 측면을 적절하게 보호하는 방법을 이해하는 것이 중요합니다.

1.1.1. 컨테이너 보안

OpenShift Container Platform 보안을 이해하기 위한 좋은 시작점은 컨테이너 보안 이해의 개념을 검토하는 것입니다. 이 섹션에서는 호스트 계층, 컨테이너 및 오케스트레이션 계층, 빌드 및 애플리케이션 계층에 대한 솔루션을 포함하여 OpenShift Container Platform에서 사용할 수 있는 컨테이너 보안 조치의 수준 높은 검토 단계를 제공합니다. 이 섹션에는 다음 주제에 대한 정보도 포함되어 있습니다.

- 컨테이너 보안이 중요한 이유 및 기존 보안 표준과의 비교

- 호스트(RHCOS 및 RHEL) 계층에서 제공하는 컨테이너 보안 조치와 OpenShift Container Platform에서 제공하는 컨테이너 보안 조치

- 컨테이너 콘텐츠 및 취약점의 소스를 평가하는 방법

- 컨테이너 콘텐츠를 사전 예방식으로 확인하기 위해 빌드 및 배포 프로세스를 디자인하는 방법

- 인증 및 권한 부여를 통해 컨테이너에 대한 액세스를 제어하는 방법

- OpenShift Container Platform에서 네트워킹 및 연결된 스토리지를 보호하는 방법

- API 관리 및 SSO에 사용하는 컨테이너화된 솔루션

1.1.2. 감사

OpenShift Container Platform 감사에서는 시스템의 개별 사용자, 관리자 또는 기타 구성 요소가 시스템에 영향을 준 활동 시퀀스를 설명하는 보안 관련 레코드 집합을 제공합니다. 관리자는 감사 로그 정책 구성 및 감사 로그 보기를 수행할 수 있습니다.

1.1.3. 인증서

인증서는 다양한 구성 요소에서 클러스터에 대한 액세스 권한을 검증하는 데 사용됩니다. 관리자는 기본 ingress 인증서를 교체하거나 API 서버 인증서를 추가하거나 서비스 인증서를 추가할 수 있습니다.

클러스터에서 사용하는 인증서 유형에 대한 세부 정보를 검토할 수도 있습니다.

1.1.4. 데이터 암호화

클러스터에 etcd 암호화를 사용하여 추가 데이터 보안 계층을 제공할 수 있습니다. 예를 들어 etcd 백업이 잘못된 당사자에게 노출되는 경우 중요한 데이터의 손실을 방지할 수 있습니다.

1.1.5. 취약점 검사

관리자는 CSO(Container Security Operator)를 사용하여 취약점 검사를 실행하고 탐지된 취약점 에 대한 정보를 검토할 수 있습니다.

1.2. 컴플라이언스 개요

많은 OpenShift Container Platform 고객은 시스템을 프로덕션 환경에 도입하기 전에 일정 수준의 규제 준비 또는 컴플라이언스를 갖춰야 합니다. 이러한 규제 준비는 국가 표준, 산업 표준 또는 조직의 기업 거버넌스 프레임워크에 의해 부과될 수 있습니다.

1.2.1. 컴플라이언스 확인

관리자는 Compliance Operator를 사용하여 규정 준수 검사를 실행하고 발견된 문제에 대한 수정을 권장할 수 있습니다. oc-compliance 플러그인은 Compliance Operator와 쉽게 상호 작용할 수 있는 유틸리티 세트를 제공하는 OpenShift CLI(oc)플러그인입니다.

1.2.2. 파일 무결성 검사

관리자는 File Integrity Operator를 사용하여 클러스터 노드에서 파일 무결성 검사를 지속적으로 실행하고 수정된 파일의 로그를 제공할 수 있습니다.

2장. 컨테이너 보안

2.1. 컨테이너 보안 이해

컨테이너화된 애플리케이션은 여러 수준의 보안에 의존합니다.

컨테이너 보안은 신뢰할 수 있는 기본 컨테이너 이미지로 시작하며 CI/CD 파이프라인에 따라 진행하면서 컨테이너 빌드 프로세스를 계속합니다.

중요기본적으로 이미지 스트림은 자동으로 업데이트되지 않습니다. 이 기본 동작은 이미지 스트림에서 참조하는 이미지에 대한 보안 업데이트가 자동으로 발생하지 않기 때문에 보안 문제가 발생할 수 있습니다. 이 기본 동작을 재정의하는 방법에 대한 자세한 내용은 주기적으로 imagestreamtag 가져오기 구성을 참조하십시오.

- 배포된 컨테이너의 보안은 컨테이너가 보안 운영 체제 및 네트워크에서 실행 중이며 컨테이너와 상호 작용하는 사용자 및 호스트와 컨테이너 자체 사이에 확실한 경계가 설정되어 있는지에 따라 결정됩니다.

- 컨테이너 이미지에서 취약점을 스캔하고 취약한 이미지를 효율적으로 수정 및 교체하는 기능이 있어야 지속적인 보안이 가능합니다.

OpenShift Container Platform과 같은 플랫폼이 기본적으로 제공하는 보안 외에도 조직에는 자체 보안 요구 사항이 있습니다. OpenShift Container Platform을 데이터 센터로 가져오려면 일정 수준의 컴플라이언스 확인이 필요할 수 있습니다.

마찬가지로 조직의 보안 표준을 충족하기 위해 자체 에이전트, 특수 하드웨어 드라이버 또는 암호화 기능을 OpenShift Container Platform에 추가해야 할 수도 있습니다.

이 가이드에서는 호스트 계층, 컨테이너 및 오케스트레이션 계층, 빌드 및 애플리케이션 계층의 솔루션을 포함하여 OpenShift Container Platform에서 사용 가능한 컨테이너 보안 조치의 수준 높은 검토 단계를 제공합니다. 그런 다음 보안 조치를 달성하는 데 도움이 되는 특정 OpenShift Container Platform 설명서를 표시합니다.

이 안내서에는 다음 정보가 포함되어 있습니다.

- 컨테이너 보안이 중요한 이유 및 기존 보안 표준과의 비교

- 호스트(RHCOS 및 RHEL) 계층에서 제공하는 컨테이너 보안 조치와 OpenShift Container Platform에서 제공하는 컨테이너 보안 조치

- 컨테이너 콘텐츠 및 취약점의 소스를 평가하는 방법

- 컨테이너 콘텐츠를 사전 예방식으로 확인하기 위해 빌드 및 배포 프로세스를 디자인하는 방법

- 인증 및 권한 부여를 통해 컨테이너에 대한 액세스를 제어하는 방법

- OpenShift Container Platform에서 네트워킹 및 연결된 스토리지를 보호하는 방법

- API 관리 및 SSO에 사용하는 컨테이너화된 솔루션

이 가이드의 목표는 컨테이너화된 워크로드에 OpenShift Container Platform을 사용하여 얻을 수 있는 뛰어난 보안 이점과 Red Hat 에코시스템을 통해 컨테이너를 안전하게 만들고 유지하는 방법을 이해하는 것입니다. 또한 조직의 보안 목표를 달성하기 위해 OpenShift Container Platform에 참여하는 방법을 이해하는 데 도움이 됩니다.

2.1.1. 컨테이너 정의

컨테이너에서는 애플리케이션과 모든 종속 항목을 변경하지 않고 개발에서 테스트 및 프로덕션으로 승격할 수 있는 단일 이미지로 패키징합니다. 컨테이너는 다른 컨테이너와 밀접하게 작동하는 더 큰 애플리케이션의 일부일 수 있습니다.

컨테이너에서는 물리 서버, 가상 머신(VM) 및 프라이빗 또는 퍼블릭 클라우드와 같은 환경 및 여러 배치 대상 사이에 일관성을 제공합니다.

컨테이너를 사용하면 다음과 같은 이점이 있습니다.

| 인프라 | 애플리케이션 |

|---|---|

| 공유 Linux 운영 체제 커널의 샌드박스 애플리케이션 프로세스 | 내 애플리케이션 및 모든 종속 항목 패키징 |

| 가상 머신보다 단순하고 가벼우며 밀도가 높음 | 몇 초 안에 모든 환경에 배포하고 CI/CD 활성화 |

| 다양한 환경에 이식 가능 | 컨테이너화된 구성요소에 쉽게 액세스 및 공유 |

Linux 컨테이너에 관한 자세한 내용은 Red Hat Customer Portal의 Linux 컨테이너 이해를 참조하십시오. RHEL 컨테이너 툴에 관해 알아보려면 RHEL 제품 설명서의 컨테이너 빌드, 실행 및 관리를 참조하십시오.

2.1.2. OpenShift Container Platform의 정의

컨테이너화된 애플리케이션이 배포, 실행 및 관리되는 방식을 자동화하는 것이 OpenShift Container Platform과 같은 플랫폼의 역할입니다. OpenShift Container Platform의 핵심은 쿠버네티스 프로젝트를 사용하여 확장 가능한 데이터 센터의 여러 노드에서 컨테이너를 조정하는 엔진을 제공하는 것입니다.

쿠버네티스는 프로젝트에서 지원 가능성을 보장하지 않는 여러 다른 운영 체제 및 애드온 구성요소를 사용하여 실행할 수 있는 프로젝트입니다. 결과적으로 쿠버네티스 플랫폼마다 보안이 다를 수 있습니다.

OpenShift Container Platform은 쿠버네티스 보안을 잠그고 다양한 확장 구성요소와 플랫폼을 통합하도록 설계되었습니다. 이를 위해 OpenShift Container Platform에서는 운영 체제, 인증, 스토리지, 네트워킹, 개발 툴, 기본 컨테이너 이미지 및 기타 여러 구성요소를 포함하는 광범위한 오픈소스 기술의 Red Hat 에코 시스템을 활용합니다.

OpenShift Container Platform은 플랫폼에서 실행 중인 컨테이너화된 애플리케이션 외에도 플랫폼 자체의 취약점을 발견하고 신속하게 수정 사항을 배포하는 Red Hat의 환경을 활용할 수 있습니다. Red Hat 환경에서는 새로운 구성요소가 사용 가능하게 되면 OpenShift Container Platform과 효율적으로 통합하고 개별 고객 요구 사항에 맞게 기술을 조정하는 범위까지 기능이 확장됩니다.

2.2. 호스트 및 VM 보안 이해

컨테이너와 가상 머신 모두 호스트에서 실행 중인 애플리케이션을 운영 체제 자체에서 분리하는 방법을 제공합니다. OpenShift Container Platform에서 사용하는 운영 체제인 RHCOS를 이해하면 호스트 시스템이 컨테이너와 호스트를 서로 보호하는 방법을 알 수 있습니다.

2.2.1. RHCOS(Red Hat Enterprise Linux CoreOS)의 컨테이너 보안

컨테이너를 사용하면 동일한 커널 및 컨테이너 런타임을 통해 각 컨테이너를 가동하여 동일한 호스트에서 실행되도록 많은 애플리케이션을 배포하는 작업이 단순화됩니다. 애플리케이션은 많은 사용자가 소유할 수 있으며, 개별적으로 유지되기 때문에 서로 다르거나 호환되지 않는 버전의 애플리케이션도 문제없이 동시에 실행될 수 있습니다.

Linux에서 컨테이너는 특별한 유형의 프로세스이므로 컨테이너 보안은 여러 가지 면에서 기타 실행 중인 프로세스를 보호하는 것과 비슷합니다. 컨테이너를 실행하는 환경은 컨테이너를 서로 보호할 뿐만 아니라 호스트에서 실행 중인 다른 프로세스 및 컨테이너로부터 호스트 커널을 보호할 수 있는 운영 체제로 시작합니다.

OpenShift Container Platform 4.9는 RHEL(Red Hat Enterprise Linux)을 작업자 노드로 사용하는 옵션과 함께 RHCOS 호스트에서 실행되므로 다음 개념이 배포된 모든 OpenShift Container Platform 클러스터에 기본적으로 적용됩니다. 이러한 RHEL 보안 기능은 OpenShift Container Platform에서 컨테이너를 더 안전하게 실행할 수 있게 하는 핵심 요소입니다.

- Linux 네임스페이스를 사용하면 특정 글로벌 시스템 리소스를 추상화하여 네임스페이스에서 처리할 별도의 인스턴스로 표시할 수 있습니다. 따라서 여러 컨테이너가 충돌없이 동일한 컴퓨팅 리소스를 동시에 사용할 수 있습니다. 기본적으로 호스트와 분리된 컨테이너 네임스페이스에는 마운트 테이블, 프로세스 테이블, 네트워크 인터페이스, 사용자, 제어 그룹, UTS 및 IPC 네임스페이스가 있습니다. 호스트 네임스페이스에 직접 액세스해야 하는 컨테이너에는 높은 권한이 있어야 해당 액세스를 요청할 수 있습니다. 네임스페이스 유형에 대한 자세한 내용은 RHEL 9 컨테이너 설명서에서 컨테이너 빌드, 실행 및 관리를 참조하세요.

- SELinux에서는 컨테이너 간에 서로 격리하고 컨테이너를 호스트에서 격리된 상태로 유지하는 추가 보안 계층을 제공합니다. 관리자는 SELinux를 사용하여 모든 사용자, 애플리케이션, 프로세스 및 파일에 MAC(필수 액세스 제어)를 적용할 수 있습니다.

RHCOS에서 SELinux를 비활성화하는 것은 지원되지 않습니다.

- CGroup(제어 그룹)은 프로세스 컬렉션의 리소스 사용량(CPU, 메모리, 디스크 I/O, 네트워크 등)을 제한, 설명 및 격리합니다. CGroup을 사용하면 동일한 호스트의 컨테이너가 서로 영향을 주지 않습니다.

- 보안 컴퓨팅 모드(seccomp) 프로파일은 사용 가능한 시스템 호출을 제한하기 위해 컨테이너와 연관될 수 있습니다. seccomp에 대한 자세한 내용은 Red Hat OpenShift 보안 가이드 의 94페이지를 참조하세요.

- RHCOS를 사용하여 컨테이너를 배포하면 호스트 환경을 최소화하고 컨테이너에 맞게 조정하여 공격 면적을 줄입니다. CRI-O 컨테이너 엔진은 데스크톱 지향 독립 실행형 기능을 구현하는 다른 컨테이너 엔진과 달리 컨테이너를 실행하고 관리하기 위해 쿠버네티스 및 OpenShift Container Platform에 필요한 기능만 구현하여 공격 면적을 더 줄입니다.

RHCOS는 OpenShift Container Platform 클러스터에서 컨트롤 플레인(마스터) 및 작업자 노드로 작동하도록 특별히 구성된 RHEL(Red Hat Enterprise Linux) 버전입니다. 따라서 RHCOS는 쿠버네티스 및 OpenShift Container Platform 서비스와 함께 컨테이너 워크로드를 효율적으로 실행하도록 조정됩니다.

OpenShift Container Platform 클러스터에서 RHCOS 시스템을 추가로 보호하려면 호스트 시스템 자체를 관리하거나 모니터링하는 컨테이너를 제외한 대부분의 컨테이너는 루트가 아닌 사용자로 실행해야 합니다. 고유한 OpenShift Container Platform 클러스터를 보호하는 데 권장되는 모범 사례는 권한 수준을 낮추거나 가능한 최소 권한으로 컨테이너를 생성하는 것입니다.

2.2.2. 가상화 및 컨테이너 비교

기존 가상화에서는 동일한 물리적 호스트에서 애플리케이션 환경을 분리한 상태로 유지할 수 있는 또 다른 방법을 제공합니다. 그러나 가상 머신은 컨테이너와 다른 방식으로 작동합니다. 가상화는 게스트 가상 머신(VM)을 가동시키는 하이퍼바이저를 사용하며, 각 가상 머신에는 실행 중인 커널로 표시되는 자체 운영 체제(OS)와 실행 중인 애플리케이션 및 해당 종속 항목이 있습니다.

VM을 사용하면 하이퍼바이저에서 게스트 간에 서로 분리하고 호스트 커널에서 게스트를 분리합니다. 하이퍼바이저에 액세스하는 개인과 프로세스 수가 적어지므로 물리 서버의 공격 면적을 줄입니다. 보안은 여전히 모니터링해야 하지만, 하나의 게스트 VM은 하이퍼바이저 버그를 사용하여 다른 VM 또는 호스트 커널에 액세스할 수 있습니다. 또한 OS에 패치가 필요한 경우 해당 OS를 사용하는 모든 게스트 VM에서 패치를 적용해야 합니다.

컨테이너는 게스트 VM 내부에서 실행될 수 있으며 이와 같은 조치 바람직한 경우가 있을 수 있습니다. 예를 들어, 애플리케이션을 클라우드로 수정 없이 그대로 리프트 앤 시프트(lift-and-shift) 방식으로 배포하고 이동하기 위해 컨테이너에 기존 애플리케이션을 배포할 수 있습니다.

그러나 단일 호스트에서 컨테이너를 분리하면 더 가볍고 유연하며 쉽게 확장되는 배포 솔루션이 제공됩니다. 이 배포 모델은 특히 클라우드 네이티브 애플리케이션에 적합합니다. 컨테이너는 일반적으로 VM보다 훨씬 작으며 메모리와 CPU 사용량이 적습니다.

컨테이너와 VM의 차이점에 관해 알아보려면 RHEL 7 컨테이너 설명서의 Linux 컨테이너와 KVM 가상화 비교를 참조하십시오.

2.2.3. OpenShift Container Platform 보호

OpenShift Container Platform을 배포할 때 설치 프로그램 프로비저닝 인프라(사용 가능한 플랫폼이 여러 개) 또는 사용자가 프로비저닝한 자체 인프라 중에서 선택할 수 있습니다. FIPS 컴플라이언스 활성화 또는 첫 부팅 시 필요한 커널 모듈 추가와 같은 일부 낮은 수준의 보안 관련 구성에 사용자가 프로비저닝한 인프라를 활용할 수 있습니다. 마찬가지로 사용자 프로비저닝 인프라는 연결 해제된 OpenShift Container Platform 배포에 적합합니다.

OpenShift Container Platform의 보안 향상 및 기타 구성 변경과 관련된 목표는 다음과 같습니다.

- 기본 노드를 최대한 일반적으로 유지합니다. 비슷한 노드를 신속하고 규범에 맞는 방식으로 쉽게 제거하고 구동할 수 있어야 합니다.

- 노드를 일회성으로 직접 변경하지 말고 최대한 OpenShift Container Platform에서 노드 수정을 관리합니다.

이러한 목표를 달성하기 위해 대부분의 노드 변경은 설치 중 Ignition을 사용하거나 나중에 Machine Config Operator가 노드 세트에 적용하는 MachineConfig를 사용하여 수행해야 합니다. 이러한 방식으로 수행할 수 있는 보안 관련 구성 변경의 예는 다음과 같습니다.

- 커널 인수 추가

- 커널 모듈 추가

- FIPS 암호화 지원 활성화

- 디스크 암호화 구성

- chrony 타임 서비스 구성

Machine Config Operator 외에도 CVO(Cluster Version Operator)에서 관리하며 OpenShift Container Platform 인프라를 구성하는 데 사용할 수 있는 Operator는 여러 가지가 있습니다. CVO를 사용하면 OpenShift Container Platform 클러스터 업데이트의 여러 요소를 자동화할 수 있습니다.

2.3. RHCOS 강화

RHCOS는 RHCOS 노드에 필요한 변경이 거의 없이 OpenShift Container Platform에 배포되도록 생성되고 조정되었습니다. OpenShift Container Platform을 채택한 모든 조직에는 시스템 강화를 위한 고유 요구 사항이 있습니다. OpenShift 고유 수정 사항 및 기능(예: 제한된 불변성을 제공하는 Ignition, ostree 및 읽기 전용 /usr 등)이 추가된 RHEL 시스템으로 RHCOS는 다른 RHEL 시스템과 마찬가지로 강화될 수 있습니다. 차이점은 강화 관리 방법에 있습니다.

OpenShift Container Platform과 쿠버네티스 엔진의 주요 기능은 필요에 따라 애플리케이션과 인프라를 빠르게 확장하고 축소할 수 있다는 것입니다. 불가피한 경우가 아니라면 호스트에 로그인하고 소프트웨어를 추가하거나 설정을 변경하여 RHCOS를 직접 변경하지 않게 합니다. OpenShift Container Platform 설치 프로그램 및 컨트롤 플레인에서 RHCOS의 변경 사항을 관리하여 수동 조작없이 새 노드를 구동할 수 있습니다.

따라서 보안 요구 사항을 충족하기 위해 OpenShift Container Platform에서 RHCOS 노드를 강화하려는 경우 강화할 대상과 강화를 수행하는 방법을 모두 고려해야 합니다.

2.3.1. RHCOS에서 강화할 대상 선택

RHEL 시스템의 보안에 접근하는 방법에 대한 자세한 내용은 RHEL 9 보안 강화 가이드를 참조하세요.

이 가이드를 사용하여 암호화에 접근하고 취약점을 평가하며 다양한 서비스에 대한 위협을 평가하는 방법을 알아봅니다. 마찬가지로 컴플라이언스 표준을 스캔하고, 파일 무결성을 확인하며, 감사를 수행하고, 스토리지 장치를 암호화하는 방법을 배울 수 있습니다.

강화하려는 기능에 관한 지식을 통해 RHCOS에서 강화할 방법을 결정할 수 있습니다.

2.3.2. RHCOS 강화 방법 선택

OpenShift Container Platform에서 RHCOS 시스템을 직접 수정하지 않는 것이 좋습니다. 대신 작업자 노드 및 컨트롤 플레인 노드와 같은 노드 풀의 시스템 수정을 고려해야 합니다. 베어 메탈이 아닌 설치에서 새 노드가 필요한 경우 원하는 유형의 새 노드를 요청할 수 있으며 RHCOS 이미지와 이전에 수정한 사항으로 노드를 생성합니다.

설치 전, 설치 중 및 클러스터가 가동되어 실행된 후에 RHCOS를 수정할 기회가 있습니다.

2.3.2.1. 설치 전 강화

베어 메탈 설치의 경우 OpenShift Container Platform 설치를 시작하기 전에 RHCOS에 강화 기능을 추가할 수 있습니다. 예를 들어, RHCOS 설치 프로그램을 부팅할 때 커널 옵션을 추가하여 SELinux 또는 다양한 하위 수준 설정(예: 대칭 멀티스레딩)과 같은 보안 기능을 켜거나 끌 수 있습니다.

RHCOS 노드에서 SELinux를 비활성화하는 것은 지원되지 않습니다.

베어 메탈 RHCOS 설치는 더 어렵지만 OpenShift Container Platform 설치를 시작하기 전에 운영 체제를 변경할 수 있는 기회를 제공합니다. 디스크 암호화 또는 특수 네트워킹 설정과 같은 특정 기능을 가능한 빨리 설정해야 할 때 중요할 수 있습니다.

2.3.2.2. 설치 중 강화

OpenShift Container Platform 설치 프로세스를 중단하고 Ignition 구성을 변경할 수 있습니다. Ignition 구성을 통해 자체 파일 및 systemd 서비스를 RHCOS 노드에 추가할 수 있습니다. 또한 설치에 사용되는 install-config.yaml 파일에서 기본 보안 관련 사항을 변경할 수 있습니다. 이 방식으로 추가된 콘텐츠는 각 노드의 첫 부팅 시 사용할 수 있습니다.

2.3.2.3. 클러스터가 실행된 후 강화

OpenShift Container Platform 클러스터가 가동되어 실행된 후 RHCOS에 강화 기능을 적용하는 방법은 몇 가지가 있습니다.

-

데몬 세트: 모든 노드에서 서비스를 실행해야 하는 경우 Kubernetes

DaemonSet오브젝트로 해당 서비스를 추가할 수 있습니다. -

머신 구성:

MachineConfig오브젝트에는 동일한 형식의 Ignition 구성 서브 세트가 있습니다. 머신 구성을 모든 작업자 또는 컨트롤 플레인 노드에 적용하면 클러스터에 추가된 동일한 유형의 다음 노드에 동일한 변경 사항이 적용될 수 있습니다.

여기에 언급된 모든 기능은 OpenShift Container Platform 제품 설명서에 설명되어 있습니다.

2.4. 컨테이너 이미지 서명

Red Hat은 Red Hat Container Registries에 있는 이미지에 대한 서명을 제공합니다. 이러한 서명은 MCO(Machine Config Operator)를 사용하여 OpenShift Container Platform 4 클러스터로 가져올 때 자동으로 확인할 수 있습니다.

Quay.io는 OpenShift Container Platform을 구성하는 대부분의 이미지를 제공하며 릴리스 이미지만 서명됩니다. 릴리스 이미지는 승인된 OpenShift Container Platform 이미지를 참조하여 공급 체인 공격에 대한 보안 수준을 제공합니다. 그러나 로깅, 모니터링 및 서비스 메시와 같은 OpenShift Container Platform에 대한 일부 확장 기능은 OLM(Operator Lifecycle Manager)에서 Operator로 제공됩니다. 이러한 이미지는 Red Hat Ecosystem Catalog 컨테이너 이미지 레지스트리에서 제공됩니다.

Red Hat 레지스트리와 인프라 간의 이미지의 무결성을 확인하려면 서명 확인을 활성화하십시오.

2.4.1. Red Hat Container Registries에 대한 서명 확인 활성화

Red Hat Container Registries에 대한 컨테이너 서명 검증을 활성화하려면 이러한 레지스트리의 이미지를 확인하는 키를 지정하는 서명 확인 정책 파일을 작성해야 합니다. RHEL8 노드의 경우 레지스트리는 기본적으로 /etc/containers/registries.d 에 정의되어 있습니다.

프로세스

작업자 노드에 필요한 구성이 포함된 Butane 구성 파일

51-worker-rh-registry-trust.bu를 만듭니다.참고구성 파일에서 지정하는 Butane 버전은 OpenShift Container Platform 버전과 일치해야 하며 항상

0으로 끝나야 합니다. 예를 들어,4.19.0입니다. Butane에 대한 자세한 내용은 “Butane 을 사용하여 머신 구성 생성”을 참조하십시오.variant: openshift version: 4.19.0 metadata: name: 51-worker-rh-registry-trust labels: machineconfiguration.openshift.io/role: worker storage: files: - path: /etc/containers/policy.json mode: 0644 overwrite: true contents: inline: | { "default": [ { "type": "insecureAcceptAnything" } ], "transports": { "docker": { "registry.access.redhat.com": [ { "type": "signedBy", "keyType": "GPGKeys", "keyPath": "/etc/pki/rpm-gpg/RPM-GPG-KEY-redhat-release" } ], "registry.redhat.io": [ { "type": "signedBy", "keyType": "GPGKeys", "keyPath": "/etc/pki/rpm-gpg/RPM-GPG-KEY-redhat-release" } ] }, "docker-daemon": { "": [ { "type": "insecureAcceptAnything" } ] } } }Butane을 사용하여 작업자 노드의 디스크에 작성할 파일이 포함된 머신 구성 YAML 파일

51-worker-rh-registry-trust.yaml을 생성합니다.$ butane 51-worker-rh-registry-trust.bu -o 51-worker-rh-registry-trust.yaml생성된 머신 구성을 적용합니다.

$ oc apply -f 51-worker-rh-registry-trust.yaml작업자 머신 구성 풀이 새 머신 구성으로 롤아웃되었는지 확인하세요.

새로운 머신 구성이 생성되었는지 확인하세요.

$ oc get mc샘플 출력

NAME GENERATEDBYCONTROLLER IGNITIONVERSION AGE 00-master a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 25m 00-worker a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 25m 01-master-container-runtime a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 25m 01-master-kubelet a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 25m 01-worker-container-runtime a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 25m 01-worker-kubelet a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 25m 51-master-rh-registry-trust 3.5.0 13s 51-worker-rh-registry-trust 3.5.0 53s1 99-master-generated-crio-seccomp-use-default 3.5.0 25m 99-master-generated-registries a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 25m 99-master-ssh 3.2.0 28m 99-worker-generated-crio-seccomp-use-default 3.5.0 25m 99-worker-generated-registries a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 25m 99-worker-ssh 3.2.0 28m rendered-master-af1e7ff78da0a9c851bab4be2777773b a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 8s rendered-master-cd51fd0c47e91812bfef2765c52ec7e6 a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 24m rendered-worker-2b52f75684fbc711bd1652dd86fd0b82 a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 24m rendered-worker-be3b3bce4f4aa52a62902304bac9da3c a2178ad522c49ee330b0033bb5cb5ea132060b0a 3.5.0 48s2 작업자 머신 구성 풀이 새 머신 구성으로 업데이트되는지 확인하세요.

$ oc get mcp샘플 출력

NAME CONFIG UPDATED UPDATING DEGRADED MACHINECOUNT READYMACHINECOUNT UPDATEDMACHINECOUNT DEGRADEDMACHINECOUNT AGE master rendered-master-af1e7ff78da0a9c851bab4be2777773b True False False 3 3 3 0 30m worker rendered-worker-be3b3bce4f4aa52a62902304bac9da3c False True False 3 0 0 0 30m1 - 1

UPDATING필드가True인 경우, 머신 구성 풀이 새로운 머신 구성으로 업데이트됩니다. 필드가False가되면 작업자 머신 구성 풀이 새 머신 구성으로 롤아웃됩니다.

클러스터에서 RHEL7 워커 노드를 사용하는 경우 워커 머신 구성 풀이 업데이트되면

/etc/containers/registries.d디렉토리에 있는 해당 노드의 YAML 파일을 생성합니다. 이 파일은 지정된 레지스트리 서버에 대한 분리된 서명의 위치를 지정합니다. 다음 예제는registry.access.redhat.com및registry.redhat.io에 호스팅된 이미지에만 적용됩니다.각 RHEL7 작업자 노드에 대한 디버그 세션을 시작합니다.

$ oc debug node/<node_name>루트 디렉토리를

/host로 변경합니다.sh-4.2# chroot /host다음 내용을 포함하는

/etc/containers/registries.d/registry.redhat.io.yaml파일을 만듭니다.docker: registry.redhat.io: sigstore: https://registry.redhat.io/containers/sigstore다음 내용을 포함하는

/etc/containers/registries.d/registry.access.redhat.com.yaml파일을 만듭니다.docker: registry.access.redhat.com: sigstore: https://access.redhat.com/webassets/docker/content/sigstore- 디버그 세션을 종료합니다.

2.4.2. 서명 확인 구성 확인

머신 구성을 클러스터에 적용한 후 머신 구성 컨트롤러에서 새 MachineConfig 오브젝트를 감지하고 새로운 rendered-worker-<hash> 버전을 생성합니다.

사전 요구 사항

- 머신 구성 파일을 사용하여 서명 확인 활성화로 설정해야 합니다.

프로세스

명령줄에서 다음 명령을 실행하여 원하는 작업자에 대한 정보를 표시합니다.

$ oc describe machineconfigpool/worker초기 작업자 모니터링의 출력 예

Name: worker Namespace: Labels: machineconfiguration.openshift.io/mco-built-in= Annotations: <none> API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfigPool Metadata: Creation Timestamp: 2019-12-19T02:02:12Z Generation: 3 Resource Version: 16229 Self Link: /apis/machineconfiguration.openshift.io/v1/machineconfigpools/worker UID: 92697796-2203-11ea-b48c-fa163e3940e5 Spec: Configuration: Name: rendered-worker-f6819366eb455a401c42f8d96ab25c02 Source: API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 00-worker API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 01-worker-container-runtime API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 01-worker-kubelet API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 51-worker-rh-registry-trust API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 99-worker-92697796-2203-11ea-b48c-fa163e3940e5-registries API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 99-worker-ssh Machine Config Selector: Match Labels: machineconfiguration.openshift.io/role: worker Node Selector: Match Labels: node-role.kubernetes.io/worker: Paused: false Status: Conditions: Last Transition Time: 2019-12-19T02:03:27Z Message: Reason: Status: False Type: RenderDegraded Last Transition Time: 2019-12-19T02:03:43Z Message: Reason: Status: False Type: NodeDegraded Last Transition Time: 2019-12-19T02:03:43Z Message: Reason: Status: False Type: Degraded Last Transition Time: 2019-12-19T02:28:23Z Message: Reason: Status: False Type: Updated Last Transition Time: 2019-12-19T02:28:23Z Message: All nodes are updating to rendered-worker-f6819366eb455a401c42f8d96ab25c02 Reason: Status: True Type: Updating Configuration: Name: rendered-worker-d9b3f4ffcfd65c30dcf591a0e8cf9b2e Source: API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 00-worker API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 01-worker-container-runtime API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 01-worker-kubelet API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 99-worker-92697796-2203-11ea-b48c-fa163e3940e5-registries API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 99-worker-ssh Degraded Machine Count: 0 Machine Count: 1 Observed Generation: 3 Ready Machine Count: 0 Unavailable Machine Count: 1 Updated Machine Count: 0 Events: <none>oc describe명령을 다시 실행합니다.$ oc describe machineconfigpool/worker작업자가 업데이트된 후 출력 예

... Last Transition Time: 2019-12-19T04:53:09Z Message: All nodes are updated with rendered-worker-f6819366eb455a401c42f8d96ab25c02 Reason: Status: True Type: Updated Last Transition Time: 2019-12-19T04:53:09Z Message: Reason: Status: False Type: Updating Configuration: Name: rendered-worker-f6819366eb455a401c42f8d96ab25c02 Source: API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 00-worker API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 01-worker-container-runtime API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 01-worker-kubelet API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 51-worker-rh-registry-trust API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 99-worker-92697796-2203-11ea-b48c-fa163e3940e5-registries API Version: machineconfiguration.openshift.io/v1 Kind: MachineConfig Name: 99-worker-ssh Degraded Machine Count: 0 Machine Count: 3 Observed Generation: 4 Ready Machine Count: 3 Unavailable Machine Count: 0 Updated Machine Count: 3 ...참고Observed Generation매개변수는 컨트롤러에서 생성된 구성의 생성에 따라 증가된 개수를 보여줍니다. 이 컨트롤러는 사양을 처리하고 수정본을 생성하지 못하더라도 이 값을 업데이트합니다.Configuration Source값은51-worker-rh-registry-trust구성을 나타냅니다.다음 명령을 사용하여

policy.json파일이 있는지 확인합니다.$ oc debug node/<node> -- chroot /host cat /etc/containers/policy.json출력 예

Starting pod/<node>-debug ... To use host binaries, run `chroot /host` { "default": [ { "type": "insecureAcceptAnything" } ], "transports": { "docker": { "registry.access.redhat.com": [ { "type": "signedBy", "keyType": "GPGKeys", "keyPath": "/etc/pki/rpm-gpg/RPM-GPG-KEY-redhat-release" } ], "registry.redhat.io": [ { "type": "signedBy", "keyType": "GPGKeys", "keyPath": "/etc/pki/rpm-gpg/RPM-GPG-KEY-redhat-release" } ] }, "docker-daemon": { "": [ { "type": "insecureAcceptAnything" } ] } } }다음 명령을 사용하여

registry.redhat.io.yaml파일이 있는지 확인합니다.$ oc debug node/<node> -- chroot /host cat /etc/containers/registries.d/registry.redhat.io.yaml출력 예

Starting pod/<node>-debug ... To use host binaries, run `chroot /host` docker: registry.redhat.io: sigstore: https://registry.redhat.io/containers/sigstore다음 명령을 사용하여

registry.access.redhat.yaml파일이 있는지 확인합니다.$ oc debug node/<node> -- chroot /host cat /etc/containers/registries.d/registry.access.redhat.com.yaml출력 예

Starting pod/<node>-debug ... To use host binaries, run `chroot /host` docker: registry.access.redhat.com: sigstore: https://access.redhat.com/webassets/docker/content/sigstore

2.4.3. 검증 가능한 서명이 없는 컨테이너 이미지의 검증 이해

각 OpenShift Container Platform 릴리스 이미지는 변경 불가능하며 Red Hat 프로덕션 키로 서명됩니다. OpenShift Container Platform 업데이트 또는 설치 중에 릴리스 이미지는 검증 가능한 서명이 없는 컨테이너 이미지를 배포할 수 있습니다. 서명된 각 릴리스 이미지 다이제스트는 변경할 수 없습니다. 릴리스 이미지의 각 참조는 다른 이미지의 변경 불가능한 다이제스트를 참조하므로 내용을 전이적으로 신뢰할 수 있습니다. 즉, 릴리스 이미지의 서명은 모든 릴리스 내용을 검증합니다.

예를 들어, 검증 가능한 서명이 없는 이미지 참조는 서명된 OpenShift Container Platform 릴리스 이미지에 포함되어 있습니다.

릴리스 정보 출력 예시

$ oc adm release info quay.io/openshift-release-dev/ocp-release@sha256:2309578b68c5666dad62aed696f1f9d778ae1a089ee461060ba7b9514b7ca417 -o pullspec

quay.io/openshift-release-dev/ocp-v4.0-art-dev@sha256:9aafb914d5d7d0dec4edd800d02f811d7383a7d49e500af548eab5d00c1bffdb 2.4.3.1. 업데이트 중 자동 검증

서명 확인은 자동으로 이루어집니다. OpenShift 클러스터 버전 운영자(CVO)는 OpenShift 컨테이너 플랫폼 업데이트 중에 릴리스 이미지의 서명을 확인합니다. 이는 내부적인 프로세스입니다. 자동 검증에 실패하면 OpenShift Container Platform 설치 또는 업데이트가 실패합니다.

Skopeo 명령줄 유틸리티를 사용하여 수동으로 서명을 검증할 수도 있습니다.

2.4.3.2. Skopeo를 사용하여 Red Hat 컨테이너 이미지의 서명 확인

OCP 릴리스 미러 사이트 에서 해당 서명을 가져와서 OpenShift Container Platform 릴리스 이미지에 포함된 컨테이너 이미지의 서명을 확인할 수 있습니다. 미러 사이트의 서명은 Podman이나 CRI-O에서 쉽게 이해할 수 있는 형식이 아니므로 skopeo standalone-verify 명령을 사용하여 릴리스 이미지가 Red Hat에서 서명되었는지 확인할 수 있습니다.

사전 요구 사항

-

Skopeo명령줄 유틸리티를 설치했습니다.

프로세스

다음 명령을 실행하여 릴리스에 대한 전체 SHA를 얻으세요.

$ oc adm release info <release_version> \1 - 1

- <release_version>을 릴리스 번호로 바꾸세요(예:

4.14.3).

출력 스니펫 예

--- Pull From: quay.io/openshift-release-dev/ocp-release@sha256:e73ab4b33a9c3ff00c9f800a38d69853ca0c4dfa5a88e3df331f66df8f18ec55 ---다음 명령을 실행하여 Red Hat 릴리스 키를 다운로드하세요.

$ curl -o pub.key https://access.redhat.com/security/data/fd431d51.txt다음 명령을 실행하여 검증하려는 특정 릴리스에 대한 서명 파일을 가져옵니다.

$ curl -o signature-1 https://mirror.openshift.com/pub/openshift-v4/signatures/openshift-release-dev/ocp-release/sha256=<sha_from_version>/signature-1 \1 - 1

<sha_from_version>을릴리스의 SHA와 일치하는 미러 사이트의 전체 링크의 SHA 값으로 바꾸세요. 예를 들어 4.12.23 릴리스의 서명 링크는https://mirror.openshift.com/pub/openshift-v4/signatures/openshift-release-dev/ocp-release/sha256%e73ab4b33a9c3ff00c9f800a38d69853ca0c4dfa5a88e3df331f66df8f18ec55/signature-1이며 SHA 값은 e73ab4b33a9c3ff00c9f800a38d69853ca0c4dfa5a88e3df331f18f18ec55 입니다.

다음 명령을 실행하여 릴리스 이미지에 대한 매니페스트를 가져옵니다.

$ skopeo inspect --raw docker://<quay_link_to_release> > manifest.json \1 - 1

<quay_link_to_release>를oc adm release info명령의 출력으로 바꾸세요. 예를 들어,quay.io/openshift-release-dev/ocp-release@sha256:e73ab4b33a9c3ff00c9f800a38d69853ca0c4dfa5a88e3df331f66df8f18ec55.

Skopeo를 사용하여 서명을 확인하세요.

$ skopeo standalone-verify manifest.json quay.io/openshift-release-dev/ocp-release:<release_number>-<arch> any signature-1 --public-key-file pub.key다음과 같습니다.

<release_number>-

릴리스 번호를 지정합니다(예:

4.14.3). <arch>예를 들어

x86_64와 같이 아키텍처를 지정합니다.출력 예

Signature verified using fingerprint 567E347AD0044ADE55BA8A5F199E2F91FD431D51, digest sha256:e73ab4b33a9c3ff00c9f800a38d69853ca0c4dfa5a88e3df331f66df8f18ec55

2.5. 컴플라이언스 이해

많은 OpenShift Container Platform 고객은 시스템을 프로덕션 환경에 도입하기 전에 일정 수준의 규제 준비 또는 컴플라이언스를 갖춰야 합니다. 이러한 규정 준비는 국가 표준, 산업 표준 또는 조직의 기업 거버넌스 프레임워크에 따라 규정될 수 있습니다.

2.5.1. 컴플라이언스 및 위험 관리 이해

FIPS 컴플라이언스는 보안 수준이 높은 환경에서 요구되는 가장 중요한 구성요소 중 하나로, 지원되는 암호화 기술만 노드에서 허용합니다.

FIPS 모드를 활성화하려면 FIPS 모드에서 작동하도록 구성된 RHEL(Red Hat Enterprise Linux) 컴퓨터에서 설치 프로그램을 실행해야 합니다. RHEL에서 FIPS 모드를 구성하는 방법에 대한 자세한 내용은 RHEL을 FIPS 모드로 전환을 참조하세요.

FIPS 모드로 부팅된 Red Hat Enterprise Linux(RHEL) 또는 Red Hat Enterprise Linux CoreOS(RHCOS)를 실행할 때 OpenShift Container Platform 핵심 구성 요소는 x86_64, ppc64le 및 s390x 아키텍처에서만 FIPS 140-2/140-3 검증을 위해 NIST에 제출된 RHEL 암호화 라이브러리를 사용합니다.

OpenShift Container Platform 컴플라이언스 프레임워크에 대한 Red Hat의 관점을 이해하려면 OpenShift 보안 가이드의 위험 관리 및 규제 준비 장을 참조하십시오.

2.6. 컨테이너 콘텐츠 보안

컨테이너 내부 콘텐츠의 보안을 유지하려면 Red Hat Universal Base Image와 같은 신뢰할 수 있는 기본 이미지로 시작하고 신뢰할 수 있는 소프트웨어를 추가해야 합니다. 컨테이너 이미지의 지속적인 보안을 확인하기 위해 이미지를 스캔하는 Red Hat 도구와 타사 도구가 있습니다.

2.6.1. 컨테이너 내부 보안

애플리케이션 및 인프라는 쉽게 사용할 수 있는 구성요소로 구성되며, 대부분은 Linux 운영 체제, JBoss Web Server, PostgreSQL 및 Node.js와 같은 오픈소스 패키지입니다.

이러한 패키지의 컨테이너화된 버전도 제공됩니다. 그러나 패키지의 원래 위치, 사용된 버전, 빌드한 사람 및 악성 코드가 있는지 여부를 알아야 합니다.

답변해야 할 몇 가지 질문은 다음과 같습니다.

- 컨테이너 내부의 구성요소 때문에 인프라가 손상됩니까?

- 애플리케이션 계층에 알려진 취약점이 있습니까?

- 런타임 및 운영 체제 계층이 최신입니까?

Red Hat UBI(Universal Base Images)의 컨테이너를 빌드하여 컨테이너 이미지의 기초가 Red Hat Enterprise Linux에 포함된 동일한 RPM 패키지 소프트웨어로 구성되게 합니다. UBI 이미지를 사용하거나 재배포하는 데 서브스크립션이 필요하지 않습니다.

컨테이너 자체의 지속적인 보안을 보장하기 위해 RHEL에서 직접 사용되거나 OpenShift Container Platform에 추가된 보안 스캔 기능을 통해 사용 중인 이미지에 취약점이 있을 때 경고할 수 있습니다. OpenSCAP 이미지 스캔은 RHEL에서 사용할 수 있으며 Container Security Operator를 추가하여 OpenShift Container Platform에서 사용되는 컨테이너 이미지를 확인할 수 있습니다.

2.6.2. UBI를 사용하여 재배포 가능한 이미지 생성

컨테이너화된 애플리케이션을 생성하려면 일반적으로 운영 체제에서 제공하는 구성요소를 제공하는 신뢰할 수 있는 기본 이미지로 시작합니다. 여기에는 라이브러리, 유틸리티 및 운영 체제의 파일 시스템에서 애플리케이션에 표시될 것으로 예상되는 기타 기능이 포함됩니다.

Red Hat UBI(Universal Base Image)는 자체 컨테이너를 구축하는 모든 사용자가 Red Hat Enterprise Linux rpm 패키지 및 기타 콘텐츠를 사용하여 전적으로 구성된 컨테이너로 시작하도록 생성되었습니다. 이 UBI 이미지는 보안 패치로 최신 상태를 유지하고 고유 소프트웨어를 포함하도록 빌드된 컨테이너 이미지를 자유롭게 사용하고 재배포하도록 정기적으로 업데이트됩니다.

다른 UBI 이미지의 상태를 찾고 확인하려면 Red Hat Ecosystem Catalog를 검색하십시오. 보안 컨테이너 이미지의 생성자는 다음과 같은 일반적인 두 가지 유형의 UBI 이미지에 관심이 있을 수 있습니다.

UBI: RHEL 7, 8 및 9의 표준 UBI 이미지(

ubi7/ubi,ubi8/ubi및ubi9/ubi)와 해당 시스템 기반 최소 이미지(ubi7/ubi-minimal,ubi8/ubi-mimimal, ubi9/ubi-imimal , ubi9/ubi-minimal )가 있습니다. 이러한 이미지는 모두 표준yum및dnf명령을 사용하여 빌드한 컨테이너 이미지에 추가할 수 있는 RHEL 소프트웨어의 무료 리포지토리를 가리키도록 미리 구성되어 있습니다.참고Red Hat에서는 Fedora 및 Ubuntu와 같은 다른 배포판에서 이러한 이미지를 사용하도록 권장합니다.

-

Red Hat 소프트웨어 컬렉션: 특정 유형의 애플리케이션에 관한 기본 이미지로 사용하기 위해 생성된 이미지를 찾으려면 Red Hat Ecosystem Catalog에서

rhscl/을 검색하십시오. 예를 들어, Apache httpd(rhscl/httpd-*), Python(rhscl/python-*), Ruby(rhscl/ruby-*), Node.js(rhscl/nodejs-*) 및 Perl(rhscl/perl-*) rhscl 이미지가 있습니다.

UBI 이미지는 자유롭게 재배포할 수 있지만, 이러한 이미지에 관한 Red Hat 지원은 Red Hat 제품 서브스크립션을 통해서만 제공됩니다.

표준, 최소 및 초기화 UBI 이미지에서 사용하고 빌드하는 방법에 관한 정보는 Red Hat Enterprise Linux 설명서에서 Red Hat Universal Base 이미지 사용을 참조하십시오.

2.6.3. RHEL의 보안 스캔

RHEL(Red Hat Enterprise Linux) 시스템의 경우 OpenSCAP 스캔은 openscap-utils 패키지에서 사용할 수 있습니다. RHEL에서 openscap-podman 명령을 사용하여 이미지의 취약점을 스캔할 수 있습니다. Red Hat Enterprise Linux 설명서에서 컨테이너 및 컨테이너 이미지에서 취약점 스캔을 참조하십시오.

OpenShift Container Platform을 사용하면 CI/CD 프로세스에서 RHEL 스캐너를 활용할 수 있습니다. 예를 들어 소스 코드의 보안 결함을 테스트하는 정적 코드 분석 툴과 오픈소스 라이브러리에서 알려진 취약점과 같은 메타데이터를 제공하기 위해 해당 라이브러리르 식별하는 소프트웨어 구성 분석 툴을 통합할 수 있습니다.

2.6.3.1. OpenShift 이미지 스캔

OpenShift Container Platform에서 실행 중이고 Red Hat Quay 레지스트리에서 가져온 컨테이너 이미지의 경우 Operator를 사용하여 해당 이미지의 취약점을 나열할 수 있습니다. 선택한 네임스페이스에 추가된 이미지의 취약점 보고를 제공하기 위해 Container Security Operator는 OpenShift Container Platform에 추가할 수 있습니다.

Red Hat Quay에 대한 컨테이너 이미지 스캐닝은 Clair 에 의해 수행됩니다. Red Hat Quay에서 Clair는 RHEL, CentOS, Oracle, Alpine, Debian 및 Ubuntu 운영 체제 소프트웨어에서 빌드된 이미지의 취약점을 검색하고 보고할 수 있습니다.

2.6.4. 외부 스캔 통합

OpenShift Container Platform은 오브젝트 주석을 사용하여 기능을 확장합니다. 취약점 스캐너와 같은 외부 툴에서는 메타데이터로 이미지 오브젝트에 주석을 달아 결과를 요약하고 Pod 실행을 제어할 수 있습니다. 이 섹션에서는 이 주석의 인식된 형식을 설명하므로 유용한 데이터를 사용자에게 표시하기 위해 콘솔에서 안정적으로 사용할 수 있습니다.

2.6.4.1. 이미지 메타데이터

패키지 취약점 및 오픈소스 소프트웨어(OSS) 라이센스 컴플라이언스를 포함하여 다양한 유형의 이미지 품질 데이터가 있습니다. 또한 이 메타데이터를 제공하는 공급자가 둘 이상일 수 있습니다. 이를 위해 다음 주석 형식이 예약되어 있습니다.

quality.images.openshift.io/<qualityType>.<providerId>: {}| 구성요소 | 설명 | 허용 가능한 값 |

|---|---|---|

|

| 메타데이터 유형 |

|

|

| 공급자 ID 문자열 |

|

2.6.4.1.1. 주석 키 예

quality.images.openshift.io/vulnerability.blackduck: {}

quality.images.openshift.io/vulnerability.jfrog: {}

quality.images.openshift.io/license.blackduck: {}

quality.images.openshift.io/vulnerability.openscap: {}이미지 품질 주석의 값은 다음 형식을 준수해야 하는 구조화된 데이터입니다.

| 필드 | 필수 여부 | 설명 | 유형 |

|---|---|---|---|

|

| 예 | 공급자 표시 이름 | 문자열 |

|

| 예 | 스캔 타임스탬프 | 문자열 |

|

| 아니요 | 짧은 설명 | 문자열 |

|

| 예 | 정보 소스 또는 자세한 내용의 URL. 사용자가 데이터를 검증하려면 필수 | 문자열 |

|

| 아니요 | 스캐너 버전 | 문자열 |

|

| 아니요 | 컴플라이언스 합격 또는 불합격 | 부울 |

|

| 아니요 | 발견된 문제 요약 | 목록(아래 표 참조) |

summary 필드는 다음 형식을 준수해야 합니다.

| 필드 | 설명 | 유형 |

|---|---|---|

|

| 구성요소의 표시 레이블(예: "심각", "중요", "중간", "낮음" 또는 "상태") | 문자열 |

|

| 이 구성요소의 데이터(예: 발견된 취약점 수 또는 점수) | 문자열 |

|

|

그래픽 표시의 순서를 지정하고 할당할 수 있는 구성요소 색인입니다. 값은 | 정수 |

|

| 정보 소스 또는 자세한 내용의 URL. 선택 사항입니다. | 문자열 |

2.6.4.1.2. 주석 값 예

이 예에서는 취약성 요약 데이터 및 컴플라이언스 부울이 있는 이미지의 OpenSCAP 주석을 표시합니다.

OpenSCAP 주석

{

"name": "OpenSCAP",

"description": "OpenSCAP vulnerability score",

"timestamp": "2016-09-08T05:04:46Z",

"reference": "https://www.open-scap.org/930492",

"compliant": true,

"scannerVersion": "1.2",

"summary": [

{ "label": "critical", "data": "4", "severityIndex": 3, "reference": null },

{ "label": "important", "data": "12", "severityIndex": 2, "reference": null },

{ "label": "moderate", "data": "8", "severityIndex": 1, "reference": null },

{ "label": "low", "data": "26", "severityIndex": 0, "reference": null }

]

}이 예에서는 추가 세부 사항의 외부 URL이 있는 상태 인덱스 데이터가 있는 이미지의 Red Hat Ecosystem Catalog의 컨테이너 이미지 섹션 주석을 표시합니다.

Red Hat Ecosystem Catalog 주석

{

"name": "Red Hat Ecosystem Catalog",

"description": "Container health index",

"timestamp": "2016-09-08T05:04:46Z",

"reference": "https://access.redhat.com/errata/RHBA-2016:1566",

"compliant": null,

"scannerVersion": "1.2",

"summary": [

{ "label": "Health index", "data": "B", "severityIndex": 1, "reference": null }

]

}2.6.4.2. 이미지 오브젝트에 주석 달기

이미지 스트림 오브젝트는 OpenShift Container Platform의 최종 사용자가 작동하는 대상인 반면, 이미지 오브젝트는 보안 메타데이터로 주석을 답니다. 이미지 오브젝트는 클러스터 범위에 있으며, 여러 이미지 스트림 및 태그에서 참조할 수 있는 단일 이미지를 가리킵니다.

2.6.4.2.1. 주석 CLI 명령 예

<image>를 이미지 다이제스트로 교체합니다(예: sha256:401e359e0f45bfdcf004e258b72e253fd07fba8cc5c6f2ed4f4608fb119ecc2).

$ oc annotate image <image> \

quality.images.openshift.io/vulnerability.redhatcatalog='{ \

"name": "Red Hat Ecosystem Catalog", \

"description": "Container health index", \

"timestamp": "2020-06-01T05:04:46Z", \

"compliant": null, \

"scannerVersion": "1.2", \

"reference": "https://access.redhat.com/errata/RHBA-2020:2347", \

"summary": "[ \

{ "label": "Health index", "data": "B", "severityIndex": 1, "reference": null } ]" }'2.6.4.3. Pod 실행 제어

images.openshift.io/deny-execution 이미지 정책을 사용하여 이미지 실행 가능 여부를 프로그래밍 방식으로 제어합니다.

2.6.4.3.1. 주석 예

annotations:

images.openshift.io/deny-execution: true2.6.4.4. 통합 참조

대부분의 경우 취약성 스캐너와 같은 외부 툴은 이미지 업데이트를 감시하고 스캔을 수행하며 결과를 사용하여 관련 이미지 오브젝트에 주석을 추가하는 스크립트 또는 플러그인을 개발합니다. 일반적으로 이 자동화에서는 OpenShift Container Platform 4.9 REST API를 호출하여 주석을 작성합니다. REST API에 관한 일반 정보는 OpenShift Container Platform REST API를 참조하십시오.

2.6.4.4.1. REST API 호출 예

curl을 사용하는 다음 예제 호출은 주석의 값을 덮어씁니다. <token>, <openshift_server>, <image_id> 및 <image_annotation>의 값을 교체하십시오.

API 호출 패치

$ curl -X PATCH \

-H "Authorization: Bearer <token>" \

-H "Content-Type: application/merge-patch+json" \

https://<openshift_server>:6443/apis/image.openshift.io/v1/images/<image_id> \

--data '{ <image_annotation> }'

다음은 PATCH 페이로드 데이터의 예입니다.

호출 데이터 패치

{

"metadata": {

"annotations": {

"quality.images.openshift.io/vulnerability.redhatcatalog":

"{ 'name': 'Red Hat Ecosystem Catalog', 'description': 'Container health index', 'timestamp': '2020-06-01T05:04:46Z', 'compliant': null, 'reference': 'https://access.redhat.com/errata/RHBA-2020:2347', 'summary': [{'label': 'Health index', 'data': '4', 'severityIndex': 1, 'reference': null}] }"

}

}

}2.7. 안전하게 컨테이너 레지스트리 사용

컨테이너 레지스트리는 컨테이너 이미지를 다음에 저장합니다.

- 다른 사용자가 이미지에 액세스하도록 허용

- 이미지를 여러 버전의 이미지를 포함할 수 있는 리포지토리로 구성

- 선택적으로 다른 인증 방법을 기반으로 이미지에 대한 액세스를 제한하거나 공개적으로 사용 가능하게 합니다.

많은 사람과 조직이 이미지를 공유하는 Quay.io 및 Docker Hub와 같은 공용 컨테이너 레지스트리가 있습니다. Red Hat Registry에서는 지원되는 Red Hat 및 파트너 이미지를 제공하는 반면, Red Hat Ecosystem Catalog에서는 해당 이미지에 관한 자세한 설명 및 상태 점검을 제공합니다. 고유 레지스트리를 관리하기 위해 Red Hat Quay와 같은 컨테이너 레지스트리를 구매할 수 있습니다.

보안 관점에서 일부 레지스트리는 컨테이너의 상태를 확인하고 향상시키는 특수 기능을 제공합니다. 예를 들어, Red Hat Quay에서는 Clair 보안 스캐너를 사용한 컨테이너 취약성 스캔, GitHub 및 기타 위치에서 소스 코드가 변경될 때 이미지를 자동으로 재구성하는 빌드 트리거 및 역할 기반 액세스 제어(RBAC)를 사용하여 이미지에 대한 액세스를 보호하는 기능을 제공합니다.

2.7.1. 컨테이너의 출처를 알고 있습니까?

다운로드 및 배포된 컨테이너 이미지의 콘텐츠를 스캔하고 추적하는 데 사용할 수 있는 툴이 있습니다. 그러나 컨테이너 이미지의 공용 소스가 많이 있습니다. 공용 컨테이너 레지스트리를 사용하는 경우 신뢰할 수 있는 소스를 사용하여 보호 계층을 추가할 수 있습니다.

2.7.2. 불변의 인증된 컨테이너

불변 컨테이너를 관리할 때는 보안 업데이트를 사용하는 것이 특히 중요합니다. 불변 컨테이너는 실행 중에 변경되지 않는 컨테이너입니다. 불변 컨테이너를 배포할 때 하나 이상의 바이너리를 대체하기 위해 실행 중인 컨테이너로 들어가지 않습니다. 운영 관점에서 컨테이너를 변경하는 대신 업데이트된 컨테이너 이미지를 재빌드하고 재배포하여 컨테이너를 교체합니다.

Red Hat 인증 이미지는 다음과 같습니다.

- 플랫폼 구성 요소 또는 계층에 알려진 취약점이 없음

- 베어 메탈에서 클라우드까지 전체 RHEL 플랫폼에서 호환 가능

- Red Hat에서 지원

알려진 취약점 목록은 지속적으로 늘어나므로 시간 경과에 따라 배포된 컨테이너 이미지의 콘텐츠와 새로 다운로드한 이미지의 콘텐츠를 추적해야 합니다. RHSA(Red Hat Security Advisories)를 사용하여 Red Hat 인증 컨테이너 이미지에서 새로 발견된 문제를 경고하고 업데이트된 이미지로 안내할 수 있습니다. 또는 Red Hat Ecosystem Catalog로 이동하여 각 Red Hat 이미지에 관한 기타 보안 관련 문제를 조회할 수 있습니다.

2.7.3. Red Hat Registry 및 Ecosystem Catalog에서 컨테이너 가져오기

Red Hat에서는 Red Hat Ecosystem Catalog의 컨테이너 이미지 섹션에서 Red Hat 제품 및 파트너 제품의 인증된 컨테이너 이미지를 나열합니다. 해당 카탈로그에서 CVE, 소프트웨어 패키지 목록 및 상태 점수를 포함하여 각 이미지의 세부 정보를 볼 수 있습니다.

Red Hat 이미지는 실제로 공개 컨테이너 레지스트리(registry.access.redhat.com) 및 인증된 레지스트리(registry.redhat.io)로 표시되는 Red Hat Registry에 저장됩니다. 둘 다 기본적으로 동일한 컨테이너 이미지 세트를 포함하며 registry.redhat.io에는 Red Hat 서브스크립션 인증서로 인증해야 하는 추가 이미지가 포함됩니다.

Red Hat에서 컨테이너 콘텐츠에 취약점이 있는지 모니터링하고 정기적으로 업데이트합니다. Red Hat에서 glibc, DROWN 또는 Dirty Cow에 대한 수정 사항과 같은 보안 업데이트를 릴리스하면 영향을 받는 컨테이너 이미지도 다시 빌드되어 Red Hat Registry에 푸시됩니다.

Red Hat에서는 상태 색인을 사용하여 Red Hat Ecosystem Catalog를 통해 제공되는 각 컨테이너의 보안 위험을 반영합니다. 컨테이너에서는 Red Hat과 에라타 프로세스에서 제공하는 소프트웨어를 사용하므로 오래되어 해지된 컨테이너는 안전하지 않은 반면 새로운 컨테이너는 더 안전합니다.

컨테이너의 수명을 설명하기 위해 Red Hat Ecosystem Catalog에서는 평가 시스템을 사용합니다. 최신 등급은 이미지에 사용 가능한 가장 오래되고 가장 심각한 보안 정오표 수치입니다. "A"는 "F"보다 최신입니다. 이 평가 시스템에 관한 자세한 내용은 Red Hat Ecosystem Catalog 내부에서 사용되는 컨테이너 상태 색인 등급을 참조하십시오.

Red Hat 소프트웨어와 관련된 보안 업데이트 및 취약점에 관한 자세한 내용은 Red Hat 제품 보안 센터를 확인하십시오. Red Hat Security Advisories를 확인하여 특정 권고와 CVE를 검색하십시오.

2.7.4. OpenShift Container Registry

OpenShift Container Platform에는 컨테이너 이미지를 관리하는 데 사용할 수 있는 플랫폼의 통합 구성요소로 실행되는 프라이빗 레지스트리인 OpenShift Container Registry가 포함되어 있습니다. OpenShift Container Registry에서는 누가 어떤 컨테이너 이미지를 가져오고 푸시하는지 관리할 수 있는 역할 기반 액세스 제어를 제공합니다.

OpenShift Container Platform에서는 Red Hat Quay와 같이 이미 사용 중인 다른 프라이빗 레지스트리와의 통합도 지원합니다.

2.7.5. Red Hat Quay를 사용하여 컨테이너 저장

Red Hat Quay는 Red Hat에서 제공하는 엔터프라이즈급 컨테이너 레지스트리 제품입니다. Red Hat Quay의 개발은 업스트림 프로젝트 Quay를 통해 수행됩니다. Red Hat Quay는 온프레미스 또는 Quay.io에서 호스팅된 Red Hat Quay 버전을 통해 배포할 수 있습니다.

Red Hat Quay의 보안 관련 기능은 다음과 같습니다.

- 타임 머신: 오래된 태그가 있는 이미지가 설정된 기간이 지난 후 만료되거나 사용자가 선택한 만료 시간에 따라 만료될 수 있습니다.

- 리포지토리 미러링: 회사 방화벽 뒤에서 Red Hat Quay에 공용 리포지토리를 호스팅하는 등의 보안상의 이유 또는 성능상의 이유로 다른 레지스트리를 미러링하여 레지스트리를 사용하는 위치에 더 가깝게 유지할 수 있습니다.

- 조치 로그 스토리지: Red Hat Quay 로깅 출력을 Elasticsearch 스토리지에 저장하여 나중에 검색하고 분석할 수 있게 합니다.

- Clair : 각 컨테이너 이미지의 출처를 기반으로 다양한 Linux 취약성 데이터베이스에 대해 이미지를 스캔합니다.

- 내부 인증: 기본 로컬 데이터베이스를 사용하여 Red Hat Quay에 대한 RBAC 인증을 처리하거나 LDAP, Keystone(OpenStack), JWT 사용자 정의 인증 또는 외부 애플리케이션 토큰 인증 중에서 선택합니다.

- 외부 인증(OAuth): GitHub, GitHub Enterprise 또는 Google 인증에서 Red Hat Quay에 대한 인증을 허용합니다.

- 액세스 설정: 도커, rkt, 익명 액세스, 사용자 생성 계정, 암호화된 클라이언트 비밀번호 또는 접두사 사용자 이름 자동 완성에서 Red Hat Quay에 액세스할 수 있도록 토큰을 생성합니다.

OpenShift Container Platform과 Red Hat Quay는 지속적으로 통합되며, 특히 흥미로운 OpenShift Container Platform Operators가 여러 개 있습니다. Quay Bridge Operator를 사용하면 내부 OpenShift 이미지 레지스트리를 Red Hat Quay로 교체할 수 있습니다. Quay Container Security Operator를 사용하면 Red Hat Quay 레지스트리에서 가져온 OpenShift Container Platform에서 실행 중인 이미지의 취약점을 확인할 수 있습니다.

2.8. 빌드 프로세스 보안

컨테이너 환경에서 소프트웨어 빌드 프로세스는 애플리케이션 코드가 필수 런타임 라이브러리와 통합되는 라이프사이클의 단계입니다. 이 빌드 프로세스 관리는 소프트웨어 스택을 보호하는 데 핵심입니다.

2.8.1. 한 번 빌드하여 어디에나 배포

컨테이너 빌드를 위한 표준 플랫폼으로 OpenShift Container Platform을 사용하면 빌드 환경의 보안을 보장할 수 있습니다. "한 번만 빌드하여 어디에나 배포" 철학을 준수하면 빌드 프로세스의 제품을 프로덕션에 정확히 배포할 수 있습니다.

컨테이너의 불변성을 유지 관리하는 것도 중요합니다. 실행 중인 컨테이너에 패치를 적용하지 말고 다시 빌드하여 재배치해야 합니다.

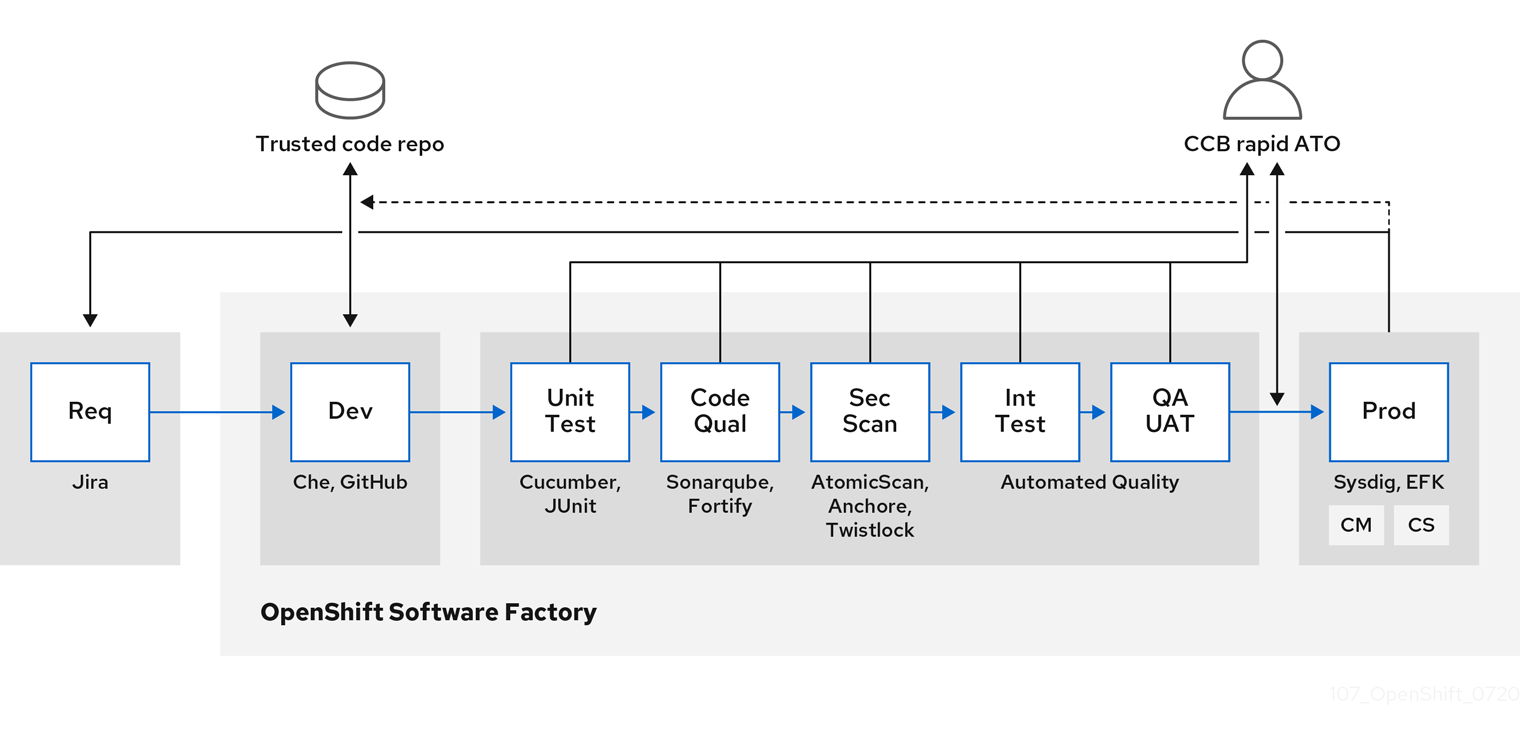

소프트웨어가 빌드, 테스트 및 프로덕션 단계를 진행해 갈 때 소프트웨어 공급망을 구성하는 툴을 신뢰하는 것이 중요합니다. 다음 그림에서는 컨테이너화된 소프트웨어를 위한 신뢰할 수 있는 소프트웨어 공급망에 통합될 수 있는 프로세스와 툴을 보여줍니다.

OpenShift Container Platform은 신뢰할 수 있는 코드 리포지토리(예: GitHub) 및 개발 플랫폼(예: Che)과 통합되어 보안 코드를 생성하고 관리할 수 있습니다. 단위 테스트에서는 Cucumber 및 JUnit을 사용합니다.

Red Hat Advanced Cluster Security for Kubernetes를 사용하면 빌드, 배포 또는 런타임 시 컨테이너의 취약점과 구성 문제를 검사할 수 있습니다. Quay에 저장된 이미지의 경우 Clair 스캐너를 사용하여 저장 중인 이미지를 검사할 수 있습니다. 또한 Red Hat 생태계 카탈로그에서 인증된 취약성 스캐너를 사용할 수 있습니다.

Sysdig와 같은 툴을 사용하면 컨테이너화된 애플리케이션을 지속적으로 모니터링할 수 있습니다.

2.8.2. 빌드 관리

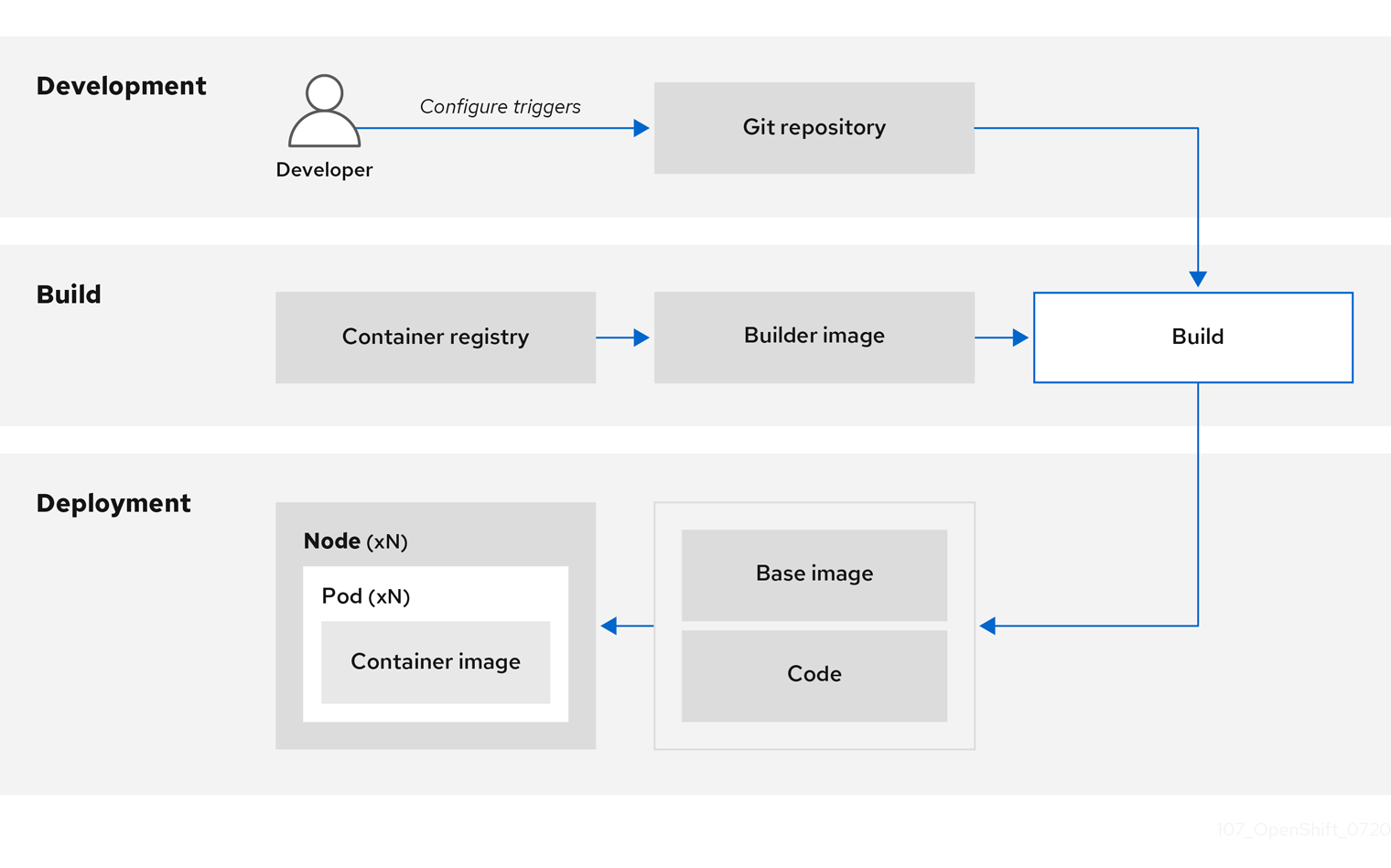

S2I(Source-to-Image)를 사용하여 소스 코드와 기본 이미지를 결합할 수 있습니다. 빌더 이미지는 S2I를 사용하므로 개발 및 운영 팀이 재현 가능한 빌드 환경에서 협업할 수 있습니다. UBI(Universal Base Image) 이미지로 사용 가능한 Red Hat S2I 이미지를 사용하면 실제 RHEL RPM 패키지에서 빌드된 기본 이미지로 소프트웨어를 자유롭게 재배포할 수 있습니다. Red Hat에서는 이를 허용하기 위해 서브스크립션 제한 사항을 제거했습니다.

개발자가 빌드 이미지를 사용하여 애플리케이션용 Git로 코드를 커밋하면 OpenShift Container Platform에서는 다음 기능을 수행할 수 있습니다.

- 사용 가능한 아티팩트, S2I 빌더 이미지 및 새로 커밋된 코드에서 자동으로 새 이미지를 어셈블링하기 위해 코드 리포지토리의 웹 후크를 사용하거나 기타 자동 연속 통합(CI) 프로세스를 사용하여 트리거합니다.

- 테스트를 위해 새로 빌드된 이미지를 자동으로 배포합니다.

- 테스트된 이미지를 CI 프로세스를 사용하여 자동으로 배포할 수 있는 프로덕션으로 승격합니다.

통합 OpenShift Container Registry를 사용하여 최종 이미지에 대한 액세스를 관리할 수 있습니다. S2I 및 기본 빌드 이미지가 자동으로 OpenShift Container Registry로 푸시됩니다.

포함된 Jenkins for CI 외에도 RESTful API를 사용하여 자체 빌드 및 CI 환경을 OpenShift Container Platform과 통합하고 API 호환 이미지 레지스트리를 사용할 수 있습니다.

2.8.3. 빌드 중 입력 보안

일부 시나리오에서는 빌드 작업을 할 때 종속 리소스에 액세스하기 위한 인증서가 필요하지만 빌드에서 생성한 최종 애플리케이션 이미지에서 해당 인증서가 사용 가능한 것은 바람직하지 않습니다. 이 목적을 위해 입력 보안을 정의할 수 있습니다.

예를 들어 Node.js 애플리케이션을 빌드할 때 Node.js 모듈에 맞게 개인용 미러를 설정할 수 있습니다. 이 개인용 미러에서 모듈을 다운로드하려면 URL, 사용자 이름 및 암호가 포함된 빌드에 사용할 사용자 정의 .npmrc 파일을 제공해야 합니다. 보안상의 이유로 애플리케이션 이미지에 자격 증명을 노출해서는 안 됩니다.

이 예제 시나리오를 사용하면 새 BuildConfig 개체에 입력 비밀번호를 추가할 수 있습니다.

프로세스

보안이 없으면 다음과 같이 생성합니다.

$ oc create secret generic secret-npmrc --from-file=.npmrc=~/.npmrc그러면

~/.npmrc파일의 base64 인코딩 콘텐츠를 포함하는secret-npmrc라는 새 보안이 생성됩니다.다음과 같이 기존

BuildConfig오브젝트의source섹션에 보안을 추가합니다.source: git: uri: https://github.com/sclorg/nodejs-ex.git secrets: - destinationDir: . secret: name: secret-npmrc새

BuildConfig오브젝트에 보안을 포함하려면 다음 명령을 실행합니다.$ oc new-build \ openshift/nodejs-010-centos7~https://github.com/sclorg/nodejs-ex.git \ --build-secret secret-npmrc

2.8.4. 빌드 프로세스 설계

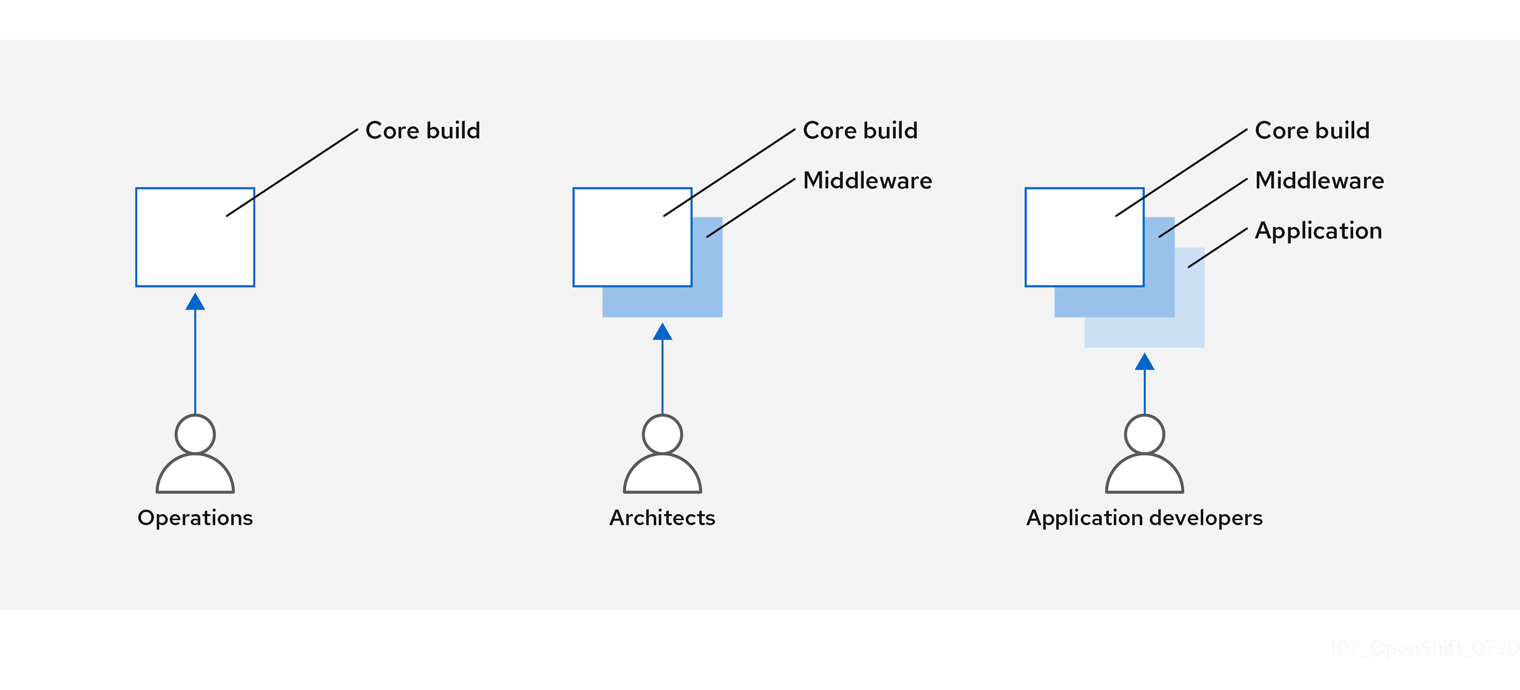

개별적으로 제어할 수 있도록 컨테이너 이미지 관리를 설계하고 컨테이너 계층을 사용하도록 프로세스를 구축할 수 있습니다.

예를 들어, 운영 팀은 기본 이미지를 관리하는 반면 아키텍트는 미들웨어, 런타임, 데이터베이스 및 기타 솔루션을 관리합니다. 그런 다음 개발자는 애플리케이션 계층과 코드 작성에 중점을 둘 수 있습니다.

매일 새로운 취약점이 식별되므로 시간 경과에 따라 컨테이너 콘텐츠를 사전 대응식으로 확인해야 합니다. 이를 위해서는 자동화된 보안 테스트를 빌드 또는 CI 프로세스에 통합해야 합니다. 예를 들면 다음과 같습니다.

- SAST/DAST – 정적 및 동적 보안 테스트 도구.

- 알려진 취약점과 비교하여 실시간 검사를 위한 스캐너. 이러한 툴을 통해서는 컨테이너의 오픈소스 패키지를 카탈로그화하고 알려진 취약점을 사용자에게 알리며 이전에 스캔한 패키지에서 새로운 취약점이 발견되면 사용자에게 이 내용을 업데이트합니다.

CI 프로세스에는 보안 스캔에서 발견된 문제로 빌드에 플래그를 표시하는 정책이 포함되어 있으므로, 팀이 해당 문제를 해결하기 위해 적절한 조치를 취할 수 있습니다. 빌드와 배포 사이에 아무것도 변경되지 않도록 사용자 정의 빌드 컨테이너에 서명해야 합니다.

GitOps 방법론을 사용하면 동일한 CI/CD 메커니즘을 사용하여 애플리케이션 구성뿐만 아니라 OpenShift Container Platform 인프라를 관리할 수 있습니다.

2.8.5. Knative 서버리스 애플리케이션 빌드

Kubernetes와 Kourier를 사용하면 OpenShift Container Platform에서 OpenShift Serverless를 사용하여 서버리스 애플리케이션을 빌드, 배포 및 관리할 수 있습니다.

다른 빌드와 마찬가지로 S2I 이미지를 사용하여 컨테이너를 빌드한 다음 Knative 서비스를 사용하여 컨테이너를 제공할 수 있습니다. OpenShift Container Platform 웹 콘솔의 토폴로지 보기를 통해 Knative 애플리케이션 빌드를 봅니다.

2.9. 컨테이너 배포

사용자가 배포한 컨테이너가 최신 프로덕션 품질의 콘텐츠를 보유하고 있으며 변경되지 않았는지 다양한 기술을 사용하여 확인할 수 있습니다. 이러한 기술에는 최신 코드를 통합하도록 빌드 트리거를 설정하는 것과 서명을 사용하여 컨테이너가 신뢰할 수 있는 소스에서 제공되었으며 수정되지 않았는지 확인하는 것이 포함됩니다.

2.9.1. 트리거를 사용하여 컨테이너 배포 제어

빌드 프로세스 중에 문제가 발생하거나 이미지가 배포된 후 취약점이 발견되면 자동화된 정책 기반 배포 도구를 사용하여 문제를 해결할 수 있습니다. 실행 중인 컨테이너에 패치를 적용하는 것이 아니라, 트리거를 사용하여 이미지를 다시 빌드하고 교체함으로써 컨테이너 프로세스가 변경되지 않게 할 수 있습니다.

예를 들어 코어, 미들웨어 및 애플리케이션의 세 가지 컨테이너 이미지 계층을 사용하여 애플리케이션을 빌드합니다. 핵심 이미지에서 문제가 발견되고 해당 이미지가 다시 빌드됩니다. 빌드가 완료되면 이미지가 OpenShift Container Registry로 푸시됩니다. OpenShift Container Platform에서 이미지가 변경되었음을 감지하고 정의된 트리거를 기반으로 애플리케이션 이미지를 자동으로 재빌드하고 배포합니다. 이 변경은 고정 라이브러리를 통합하고 프로덕션 코드가 최신 이미지와 동일하게 합니다.

oc set triggers 명령을 사용하여 배포 트리거를 설정할 수 있습니다. 예를 들어 deployment-example이라는 배포용 트리거를 설정하려면 다음을 수행합니다.

$ oc set triggers deploy/deployment-example \

--from-image=example:latest \

--containers=web2.9.2. 배포할 수 있는 이미지 소스 제어

원하는 이미지가 실제로 배포되고 포함된 콘텐츠를 포함하는 이미지가 신뢰할 수 있는 소스의 이미지이며 변경되지 않은 것이 중요합니다. 암호화 서명을 사용하면 이를 보장할 수 있습니다. OpenShift Container Platform을 사용하면 클러스터 관리자는 배포 환경 및 보안 요구 사항을 반영하여 광범위하거나 한정된 보안 정책을 적용할 수 있습니다. 이 정책을 정의하는 매개변수는 다음 두 가지입니다.

- 선택적 프로젝트 네임스페이스가 있는 레지스트리 하나 이상

- 공개 키 수락, 거부 또는 필수와 같은 신뢰 유형

이러한 정책 매개변수를 사용하여 전체 레지스트리, 레지스트리 일부 또는 개별 이미지의 신뢰 관계를 허용, 거부 또는 필수로 지정할 수 있습니다. 신뢰할 수 있는 공개 키를 사용하면 암호화 방식으로 소스를 확인할 수 있습니다. 정책 규칙은 노드에 적용됩니다. 정책은 모든 노드에 균일하게 적용되거나 다른 노드 워크로드(예 : 빌드, 영역 또는 환경)를 대상으로 할 수 있습니다.

이미지 서명 정책 파일 예

{

"default": [{"type": "reject"}],

"transports": {

"docker": {

"access.redhat.com": [

{

"type": "signedBy",

"keyType": "GPGKeys",

"keyPath": "/etc/pki/rpm-gpg/RPM-GPG-KEY-redhat-release"

}

]

},

"atomic": {

"172.30.1.1:5000/openshift": [

{

"type": "signedBy",

"keyType": "GPGKeys",

"keyPath": "/etc/pki/rpm-gpg/RPM-GPG-KEY-redhat-release"

}

],

"172.30.1.1:5000/production": [

{

"type": "signedBy",

"keyType": "GPGKeys",

"keyPath": "/etc/pki/example.com/pubkey"

}

],

"172.30.1.1:5000": [{"type": "reject"}]

}

}

}

정책은 /etc/containers/policy.json으로 노드에 저장될 수 있습니다. 이 파일을 노드에 저장할 때는 새로운 MachineConfig 오브젝트를 사용하는 것이 가장 좋습니다. 이 예에서는 다음 규칙을 적용합니다.

-

Red Hat 공개 키로 Red Hat Registry(

registry.access.redhat.com)의 이미지에 서명해야 합니다. -

openshift네임스페이스에 있는 OpenShift Container Registry의 이미지에 Red Hat 공개 키로 서명해야 합니다. -

production네임스페이스에 있는 OpenShift Container Registry의 이미지에example.com의 공개 키로 서명해야 합니다. -

글로벌

default정의로 지정되지 않은 다른 모든 레지스트리는 거부됩니다.

2.9.3. 서명 전송 사용

서명 전송은 바이너리 서명 Blob을 저장하고 검색하는 방법입니다. 서명 전송의 유형은 다음 두 가지입니다.

-

atomic: OpenShift Container Platform API에서 관리합니다. -

docker: 로컬 파일로 제공되거나 웹 서버를 통해 제공됩니다.

OpenShift Container Platform API는 atomic 전송 유형을 사용하는 서명을 관리합니다. 이 서명 유형을 사용하는 이미지를 OpenShift 컨테이너 레지스트리에 저장해야 합니다. docker/distribution extensions API에서 이미지 서명 끝점을 자동 검색하므로 추가 구성이 필요하지 않습니다.

docker 전송 유형을 사용하는 서명은 로컬 파일 또는 웹 서버에서 제공합니다. 이 서명은 더 유연합니다. 컨테이너 이미지 레지스트리에서 이미지를 제공하고 독립 서버를 사용하여 바이너리 서명을 제공할 수 있습니다.

그러나 docker 전송 유형에는 추가 구성이 필요합니다. 임의로 이름이 지정된 YAML 파일을 기본적으로 호스트 시스템의 디렉터리인 /etc/containers/registries.d에 배치하여 서명 서버의 URI로 노드를 구성해야 합니다. YAML 구성 파일에는 레지스트리 URI 및 서명 서버 URI 또는 sigstore가 포함되어 있습니다.

registries.d 파일 예

docker:

access.redhat.com:

sigstore: https://access.redhat.com/webassets/docker/content/sigstore

이 예에서 Red Hat Registry, access.redhat.com은 docker 전송 유형의 서명을 제공하는 서명 서버입니다. 해당 URI는 sigstore 매개변수에 정의되어 있습니다. 이 파일의 이름을 /etc/containers/registries.d/redhat.com.yam로 지정하고 Machine Config Operator를 사용하여 파일을 클러스터의 각 노드에 자동으로 배치합니다. 정책 및 registries.d 파일은 컨테이너 런타임을 통해 동적으로 로드되므로 서비스를 다시 시작할 필요가 없습니다.

2.9.4. 보안 및 구성 맵 생성

Secret 오브젝트 유형에서는 암호, OpenShift Container Platform 클라이언트 구성 파일, dockercfg 파일, 개인 소스 리포지토리 인증서와 같은 중요한 정보를 보유하는 메커니즘을 제공합니다. 보안은 Pod에서 민감한 콘텐츠를 분리합니다. 볼륨 플러그인을 사용하여 컨테이너에 보안을 마운트하거나 시스템에서 시크릿을 사용하여 Pod 대신 작업을 수행할 수 있습니다.

예를 들어 개인 이미지 리포지토리에 액세스할 수 있도록 배치 구성에 보안을 추가하려면 다음을 수행하십시오.

프로세스

- OpenShift Container Platform 웹 콘솔에 로그인합니다.

- 새 프로젝트를 생성합니다.

-

리소스 → 보안으로 이동하여 새 보안을 생성합니다.

보안 유형을이미지 보안으로 설정하고인증 유형을이미지 레지스트리 인증서로 설정하여 개인 이미지 리포지토리에 액세스하는 데 사용할 인증서를 입력합니다. -

배포 구성을 생성할 때(예: 프로젝트에 추가 → 이미지 배포 페이지)

가져오기 보안을 새 보안으로 설정합니다.

구성 맵은 보안과 유사하지만 민감한 정보가 포함되지 않은 문자열 작업을 지원하도록 설계되었습니다. ConfigMap 오브젝트에는 Pod에서 사용하거나 컨트롤러와 같은 시스템 구성 요소의 구성 데이터를 저장하는 데 사용할 수 있는 구성 데이터의 키-값 쌍이 있습니다.

2.9.5. 지속적인 배포 자동화

OpenShift Container Platform과 연속 배포(CD) 툴링을 통합할 수 있습니다.

CI/CD 및 OpenShift Container Platform을 활용하면 최신 수정 사항을 통합하기 위해 애플리케이션을 재빌드하고 테스트한 다음 환경 내 모든 위치에 배포되었는지 확인하는 프로세스를 자동화할 수 있습니다.

2.10. 컨테이너 플랫폼 보안

OpenShift Container Platform 및 쿠버네티스 API는 대규모 컨테이너 관리 자동화의 핵심입니다. API는 다음을 수행하는 데 사용됩니다.

- Pod, 서비스 및 복제 컨트롤러의 데이터를 검증하고 구성합니다.

- 수신 요청에서 프로젝트의 유효성을 확인하고 다른 주요 시스템 구성요소에서 트리거를 호출합니다.

쿠버네티스를 기반으로 하는 OpenShift Container Platform의 보안 관련 기능은 다음과 같습니다.

- 역할 기반 액세스 제어 및 네트워크 정책을 결합하여 컨테이너를 여러 수준으로 격리하는 멀티 테넌시.

- API와 API에 요청하는 규칙 사이의 경계를 형성하는 승인 플러그인입니다.

OpenShift Container Platform에서는 Operator를 사용하여 쿠버네티스 수준 보안 기능 관리를 자동화하고 단순화합니다.

2.10.1. 멀티 테넌시로 컨테이너 격리

다중 테넌트를 사용하면 여러 사용자가 소유하고 여러 호스트와 네임스페이스에서 실행되는 OpenShift Container Platform 클러스터의 애플리케이션을 서로 분리하고 외부 공격으로부터 격리된 상태로 유지할 수 있습니다. 쿠버네티스 네임스페이스에 역할 기반 액세스 제어(RBAC)를 적용하여 멀티 테넌시를 확보합니다.

쿠버네티스에서 네임스페이스는 다른 애플리케이션과 분리된 방식으로 애플리케이션을 실행할 수 있는 영역입니다. OpenShift Container Platform에서는 SELinux에서 MCS 레이블링을 포함하여 주석을 추가하고 이러한 확장 네임스페이스를 프로젝트로 식별하여 네임스페이스를 사용하고 확장합니다. 프로젝트 범위 내에서 서비스 계정, 정책, 제약 조건 및 기타 다양한 오브젝트를 포함하여 자체 클러스터 리소스를 유지 관리할 수 있습니다.

선택된 사용자가 프로젝트에 액세스할 수 있도록 RBAC 오브젝트가 해당 프로젝트에 할당됩니다. 이 인증에서는 규칙, 역할 및 바인딩 양식을 사용합니다.

- 규칙을 통해서는 사용자가 프로젝트에서 생성하거나 액세스할 수 있는 대상을 정의합니다.

- 역할은 선택한 사용자 또는 그룹에 바인딩할 수 있는 규칙 컬렉션입니다.

- 바인딩을 통해서는 사용자 또는 그룹과 역할 간의 연결을 정의합니다.

로컬 RBAC 역할 및 바인딩은 사용자 또는 그룹을 특정 프로젝트에 연결합니다. 클러스터 RBAC는 클러스터 전체 역할 및 바인딩을 클러스터의 모든 프로젝트에 연결할 수 있습니다. admin, basic-user, cluster-admin 및 cluster-status 액세스를 제공하기 위해 지정할 수 있는 기본 클러스터 역할이 있습니다.

2.10.2. 승인 플러그인으로 컨트롤 플레인 보호

RBAC는 사용자와 그룹 및 사용 가능한 프로젝트 간의 액세스 규칙을 제어하지만 승인 플러그인은 OpenShift Container Platform 마스터 API에 대한 액세스를 정의합니다. 승인 플러그인은 다음과 같은 일련의 규칙으로 구성됩니다.

- 기본 승인 플러그인: OpenShift Container Platform 컨트롤 플레인의 구성요소에 적용되는 기본 정책 및 리소스 제한 세트를 구현합니다.

- 변형형 입학 플러그인: 이러한 플러그인은 입학 체인을 동적으로 확장합니다. 이 플러그인은 웹 후크 서버를 호출하고 요청을 인증하며 선택된 리소스를 수정할 수 있습니다.

- 승인 플러그인 유효성 확인: 선택된 리소스에 대한 요청의 유효성을 확인하고, 요청의 유효성 확인 및 리소스가 다시 변경되지 않게 확인하는 작업을 모두 수행합니다.

API 요청이 체인의 승인 플러그인을 진행하는 중에 실패가 발생하여 요청이 거부됩니다. 각 승인 플러그인은 특정 리소스와 연관되어 있으며 해당 리소스의 요청에만 응답합니다.

2.10.2.1. SCC(보안 컨텍스트 제약 조건)

SCC(보안 컨텍스트 제약 조건 )를 사용하여 시스템에 적용하기 위해 Pod를 실행해야 하는 조건 집합을 정의할 수 있습니다.

SCC에서 관리할 수 있는 몇 가지 요소는 다음과 같습니다.

- 권한이 있는 컨테이너 실행

- 컨테이너가 추가하도록 요청할 수 있는 기능

- 호스트 디렉터리를 볼륨으로 사용

- 컨테이너의 SELinux 컨텍스트

- 컨테이너 사용자 ID

필수 권한이 있으면 필요한 경우 기본 SCC 정책의 허용 범위를 넓게 조정할 수 있습니다.

2.10.2.2. 서비스 계정에 역할 부여

사용자에게 역할 기반 액세스 권한이 할당된 방식과 동일하게 서비스 계정에 역할을 할당할 수 있습니다. 프로젝트마다 3개의 기본 서비스 계정이 생성됩니다. 서비스 계정:

- 특정 프로젝트로 범위가 제한됨

- 프로젝트에서 이름 파생

- OpenShift Container Registry에 액세스하기 위해 API 토큰 및 인증서가 자동으로 할당됨

플랫폼 구성요소와 관련된 서비스 계정의 키는 자동으로 순환됩니다.

2.10.3. 인증 및 권한 부여

2.10.3.1. OAuth를 사용하여 액세스 제어

컨테이너 플랫폼 보안을 위해 인증 및 권한 부여를 통해 API 액세스 제어를 사용할 수 있습니다. OpenShift Container Platform 마스터에는 내장 OAuth 서버가 포함되어 있습니다. 사용자가 API에 자신을 인증하기 위해 OAuth 액세스 토큰을 가져올 수 있습니다.

관리자는 LDAP, GitHub 또는 Google과 같은 ID 공급자를 사용하여 인증할 OAuth를 구성할 수 있습니다. ID 공급자는 기본적으로 새 OpenShift Container Platform 배포에 사용되지만 초기 설치 시 또는 설치 후 이 공급자를 구성할 수 있습니다.

2.10.3.2. API 액세스 제어 및 관리

애플리케이션에는 관리가 필요한 끝점이 서로 다른 여러 개의 독립적인 API 서비스가 있을 수 있습니다. OpenShift Container Platform에는 3scale API 게이트웨이의 컨테이너화된 버전이 포함되어 있으므로 API를 관리하고 액세스를 제어할 수 있습니다.

3scale에서는 API 인증 및 보안을 위한 다양한 표준 옵션을 제공합니다. 이 옵션은 표준 API 키, 애플리케이션 ID와 키 쌍 및 OAuth 2.0과 함께 인증서를 발행하고 액세스를 제어하기 위해 조합하여 사용하거나 단독으로 사용할 수 있습니다.

특정 끝점, 방법 및 서비스에 대한 액세스를 제한하고 사용자 그룹의 액세스 정책을 적용할 수 있습니다. 애플리케이션 계획을 통해 API 사용에 대한 속도 제한을 설정하고 개발자 그룹의 트래픽 흐름을 제어할 수 있습니다.

컨테이너화된 3scale API 게이트웨이인 APIcast v2를 사용하는 방법에 관한 자습서는 3scale 설명서의 Red Hat OpenShift에서 APIcast 실행을 참조하십시오.

2.10.3.3. Red Hat Single Sign-On

Red Hat Single Sign-On 서버를 사용하면 SAML 2.0, OpenID Connect 및 OAuth 2.0을 포함한 표준을 기반으로 웹 싱글 사인온 기능을 제공하여 애플리케이션을 보호할 수 있습니다. 서버는 SAML 또는 OpenID Connect 기반 ID 공급자(IdP)의 역할을 하며 엔터프라이즈 사용자 디렉터리 또는 타사 ID 공급자와 함께 표준 기반 토큰을 사용하여 ID 정보 및 애플리케이션을 중재할 수 있습니다. Red Hat Single Sign-On을 Microsoft Active Directory 및 Red Hat Enterprise Linux Identity Management를 포함한 LDAP 기반 디렉터리 서비스와 통합할 수 있습니다.

2.10.3.4. 보안 셀프 서비스 웹 콘솔

OpenShift Container Platform에서는 팀이 권한없이 다른 환경에 액세스하지 못하도록 셀프 서비스 웹 콘솔을 제공합니다. OpenShift Container Platform에서는 다음을 제공하여 보안 멀티 테넌트 마스터를 보장합니다.

- 마스터에 액세스하는 데 TLS(Transport Layer Security)를 사용합니다.

- API 서버에 액세스하는 데 X.509 인증서 또는 OAuth 액세스 토큰을 사용합니다.

- 프로젝트에 할당량을 지정하면 불량 토큰으로 인한 피해가 제한됩니다

- etcd 서비스는 클러스터에 직접 노출되지 않습니다

2.10.4. 플랫폼의 인증서 관리

OpenShift Container Platform의 프레임워크에는 TLS 인증서를 통한 암호화를 활용하는 REST 기반 HTTPS 통신을 사용하는 여러 구성요소가 있습니다. OpenShift Container Platform의 설치 관리자는 설치 중에 이러한 인증서를 구성합니다. 이 트래픽을 생성하는 몇 가지 기본 구성요소가 있습니다.

- 마스터(API 서버 및 컨트롤러)

- etcd

- 노드

- 레지스트리

- 라우터

2.10.4.1. 사용자 정의 인증서 구성

초기 설치 중 또는 인증서를 재배포할 때 API 서버와 웹 콘솔의 공개 호스트 이름에 맞게 사용자 정의 제공 인증서를 구성할 수 있습니다. 사용자 정의 CA도 사용할 수 있습니다.

2.11. 네트워크 보안

네트워크 보안은 여러 수준에서 관리할 수 있습니다. Pod 수준에서 네트워크 네임스페이스는 네트워크 액세스를 제한하여 컨테이너에 다른 Pod 또는 호스트 시스템이 표시되지 않게 할 수 있습니다. 네트워크 정책을 통해 연결을 허용하거나 거부할 수 있습니다. 컨테이너화된 애플리케이션으로 수신 및 송신되는 트래픽을 관리할 수 있습니다.

2.11.1. 네트워크 네임스페이스 사용

OpenShift Container Platform에서는 소프트웨어 정의 네트워킹(SDN)을 사용하여 클러스터 전체의 컨테이너 간 통신이 가능한 통합 클러스터 네트워크를 제공합니다.

기본적으로 네트워크 정책 모드에서는 다른 Pod 및 네트워크 끝점에서 프로젝트의 모든 Pod에 액세스 할 수 있습니다. 프로젝트에서 하나 이상의 Pod를 분리하기 위해 해당 프로젝트에서 NetworkPolicy 오브젝트를 생성하여 수신되는 연결을 표시할 수 있습니다. 다중 테넌트 모드를 사용하면 Pod 및 서비스에 대한 프로젝트 수준 격리를 제공할 수 있습니다.

2.11.2. 네트워크 정책으로 Pod 분리

네트워크 정책을 사용하면 동일한 프로젝트에서 Pod를 서로 분리할 수 있습니다. 네트워크 정책은 Pod에 대한 모든 네트워크 액세스를 거부하고 수신 컨트롤러의 연결만 허용하거나 다른 프로젝트의 Pod에서 연결을 거부하거나 네트워크 작동 방식에 관한 유사한 규칙을 설정할 수 있습니다.

2.11.3. 여러 Pod 네트워크 사용

실행 중인 각 컨테이너에는 기본적으로 하나의 네트워크 인터페이스만 있습니다. Multus CNI 플러그인을 사용하면 여러 CNI 네트워크를 만든 다음 해당 네트워크를 Pod에 연결할 수 있습니다. 이렇게 하면 개인 데이터를 더 제한된 네트워크로 분리할 수 있으며 노드마다 네트워크 인터페이스가 여러 개일 수 있습니다.

2.11.4. 애플리케이션 격리

OpenShift Container Platform을 사용하면 단일 클러스터에서 네트워크 트래픽을 세그먼트화하여 사용자, 팀, 애플리케이션 및 환경을 글로벌이 아닌 리소스와 분리하는 다중 테넌트 클러스터를 만들 수 있습니다.

2.11.5. 수신 트래픽 보안

OpenShift Container Platform 클러스터 외부에서 쿠버네티스 서비스에 대한 액세스를 구성하는 방법과 관련하여 보안에 미치는 영향이 많이 있습니다. HTTP 및 HTTPS 경로를 노출하는 외에도 수신 라우팅을 사용하면 NodePort 또는 LoadBalancer 수신 유형을 설정할 수 있습니다. NodePort에서는 각 클러스터 작업자의 애플리케이션 서비스 API 오브젝트를 노출합니다. LoadBalancer를 사용하면 OpenShift Container Platform 클러스터의 관련 서비스 API 오브젝트에 외부 로드 밸런서를 할당할 수 있습니다.

2.11.6. 송신 트래픽 보안

OpenShift Container Platform에서는 라우터 또는 방화벽 방법을 사용하여 송신 트래픽을 제어하는 기능을 제공합니다. 예를 들어, IP 허용 목록을 사용하여 데이터베이스 액세스를 제어할 수 있습니다. 클러스터 관리자는 송신 IP 주소를 구성 하여 프로젝트에 하나 이상의 송신 IP 주소를 할당할 수 있습니다. 마찬가지로 클러스터 관리자는 송신 방화벽을 사용하여 송신 트래픽이 OpenShift Container Platform 클러스터 외부로 나가는 것을 방지할 수 있습니다.

고정 송신 IP 주소를 할당하면 특정 프로젝트용으로 나가는 모든 트래픽을 해당 IP 주소에 할당할 수 있습니다. 송신 방화벽을 사용하면 Pod가 외부 네트워크에 연결 또는 Pod가 내부 네트워크에 연결하는 것을 방지하거나 특정 내부 서브넷에 대한 Pod의 액세스를 제한할 수 있습니다.

2.12. 연결된 스토리지 보안

OpenShift Container Platform에서는 온프레미스 및 클라우드 공급자를 위해 여러 유형의 스토리지를 지원합니다. 특히 OpenShift Container Platform에서는 컨테이너 스토리지 인터페이스를 지원하는 스토리지 유형을 사용할 수 있습니다.

2.12.1. 영구 볼륨 플러그인

컨테이너는 스테이트리스(stateless) 및 스테이트풀(stateful) 애플리케이션 둘 다에 유용합니다. 연결된 스토리지를 보호하는 것이 상태 저장 서비스 보안의 핵심 요소입니다. CSI(Container Storage Interface)를 사용하여 OpenShift Container Platform에서는 CSI 인터페이스를 지원하는 모든 스토리지 백엔드의 스토리지를 통합할 수 있습니다.

OpenShift Container Platform에서는 다음을 포함하여 여러 유형의 스토리지에 맞는 플러그인을 제공합니다.

- Red Hat OpenShift Data Foundation

- AWS EBS(Elastic Block Stores)*

- AWS EFS(Elastic File System)*

- Azure 디스크*

- Azure 파일*

- OpenStack Cinder*

- GCE 영구 디스크*

- VMware vSphere*

- 네트워크 파일 시스템(NFS)

- FlexVolume

- 파이버 채널

- iSCSI

동적 프로비저닝을 사용하는 스토리지 유형의 플러그인에는 별표(*)가 표시됩니다. 서로 통신 중인 모든 OpenShift Container Platform 구성요소에서 전송 중인 데이터는 HTTPS를 통해 암호화됩니다.

스토리지 유형에서 지원하는 방식으로 호스트에 영구 볼륨(PV)을 마운트할 수 있습니다. 스토리지 유형에 따라 기능이 다르며 각 PV의 액세스 모드는 해당 볼륨에서 지원하는 특정 모드로 설정됩니다.

예를 들어 NFS에서는 여러 읽기/쓰기 클라이언트를 지원할 수 있지만 특정 NFS PV는 서버에서 읽기 전용으로 내보낼 수 있습니다. 각 PV에는 ReadWriteOnce, ReadOnlyMany 및 ReadWriteMany와 같은 특정 PV 기능을 설명하는 자체 액세스 모드 세트가 있습니다.

2.12.3. 블록 스토리지

AWS EBS(Elastic Block Store), GCE 영구 디스크 및 iSCSI와 같은 블록 스토리지 공급자의 경우 OpenShift Container Platform에서는 SELinux 기능을 사용하여 권한이 없는 Pod용으로 마운트된 볼륨의 루트를 보호함으로써, 연관된 컨테이너에서만 마운트된 볼륨을 소유하고 볼 수 있게 합니다.

2.13. 클러스터 이벤트 및 로그 모니터링

OpenShift Container Platform 클러스터를 모니터링하고 감사하는 기능은 부적절한 사용으로부터 클러스터와 사용자를 보호하는 데 중요한 부분입니다.

이 용도에 유용한 클러스터 수준 정보의 두 가지 주요 소스, 즉 이벤트와 로깅이 있습니다.

2.13.1. 클러스터 이벤트 감시

클러스터 관리자는 Event 리소스 유형을 익히고 시스템 이벤트 목록을 검토하여 관심있는 이벤트를 결정하는 것이 좋습니다. 이벤트는 네임스페이스, 즉 관련 리소스의 네임스페이스 또는 클러스터 이벤트의 경우에는 default 네임스페이스와 연결됩니다. 기본 네임스페이스에는 인프라 구성요소와 관련된 노드 이벤트 및 리소스 이벤트와 같은 클러스터 모니터링 또는 감사 관련 이벤트가 있습니다.

마스터 API 및 oc 명령은 이벤트 목록의 범위를 노드 관련 항목으로만 지정하는 매개변수는 제공하지 않습니다. 간단한 접근 방식은 grep을 사용하는 것입니다.

$ oc get event -n default | grep Node출력 예

1h 20h 3 origin-node-1.example.local Node Normal NodeHasDiskPressure ...

더 유연한 접근 방식은 다른 툴에서 처리할 수 있는 양식으로 이벤트를 출력하는 것입니다. 예를 들어 다음 예에서는 JSON 출력을 대상으로 jq 툴을 사용하여 NodeHasDiskPressure 이벤트만 추출합니다.

$ oc get events -n default -o json \

| jq '.items[] | select(.involvedObject.kind == "Node" and .reason == "NodeHasDiskPressure")'출력 예

{

"apiVersion": "v1",

"count": 3,

"involvedObject": {

"kind": "Node",

"name": "origin-node-1.example.local",

"uid": "origin-node-1.example.local"

},

"kind": "Event",

"reason": "NodeHasDiskPressure",

...

}리소스 생성, 수정 또는 삭제와 관련된 이벤트도 클러스터의 오용을 탐지하는 데 적합할 수 있습니다. 예를 들어 다음과 같은 쿼리를 사용하면 과도한 이미지 가져오기를 찾을 수 있습니다.

$ oc get events --all-namespaces -o json \

| jq '[.items[] | select(.involvedObject.kind == "Pod" and .reason == "Pulling")] | length'출력 예

4네임스페이스가 삭제되면 해당 이벤트도 삭제됩니다. 이벤트도 만료될 수 있으며 etcd 스토리지가 가득 차지 않도록 삭제됩니다. 이벤트는 영구 레코드로 저장되지 않으며 시간 경과에 따른 통계를 캡처하려면 자주 폴링해야 합니다.

2.13.2. 로깅

oc log 명령을 사용하면 컨테이너 로그, 빌드 구성, 배포를 실시간으로 볼 수 있습니다. 다른 사용자는 다른 로그에 액세스할 수 있습니다.

- 프로젝트에 액세스할 수 있는 사용자는 기본적으로 해당 프로젝트의 로그를 볼 수 있습니다.

- 관리자 역할이 있는 사용자는 모든 컨테이너 로그에 액세스할 수 있습니다.

추가 감사 및 분석을 위해 로그를 저장하려면 cluster-logging 애드온 기능을 사용하여 시스템, 컨테이너 및 감사 로그를 수집, 관리 및 볼 수 있습니다. OpenShift Elasticsearch Operator 및 Red Hat OpenShift Logging Operator를 통해 OpenShift Logging을 배포, 관리 및 업그레이드할 수 있습니다.

2.13.3. 감사 로그

감사 로그를 사용하면 사용자, 관리자 또는 기타 OpenShift Container Platform 구성요소의 동작과 관련된 일련의 활동을 따를 수 있습니다. API 감사 로깅은 각 서버에서 수행됩니다.

3장. 인증서 구성

3.1. 기본 수신 인증서 교체

3.1.1. 기본 수신 인증서 이해

기본적으로 OpenShift Container Platform에서는 Ingress Operator를 사용하여 내부 CA를 생성하고 .apps 하위 도메인의 애플리케이션에 유효한 와일드카드 인증서를 발급합니다. 웹 콘솔과 CLI도 모두 이 인증서를 사용합니다.

내부 인프라 CA 인증서는 자체 서명됩니다. 이 프로세스는 일부 보안 또는 PKI 팀에서는 나쁜 습관으로 인식할 수 있지만 위험이 거의 없습니다. 이러한 인증서를 암시적으로 신뢰하는 유일한 클라이언트는 클러스터 내의 다른 구성요소입니다. 기본 와일드카드 인증서를 컨테이너 사용자 공간에서 제공한 대로 이미 CA 번들에 포함된 공용 CA에서 발행한 인증서로 교체하면 외부 클라이언트가 .apps 하위 도메인에서 실행되는 애플리케이션에 안전하게 연결할 수 있습니다.

3.1.2. 기본 수신 인증서 교체

.apps 하위 도메인에 있는 애플리케이션의 기본 수신 인증서를 교체할 수 있습니다. 인증서를 교체하고 나면 웹 콘솔 및 CLI를 포함한 모든 애플리케이션에는 지정된 인증서에서 제공하는 암호화가 생깁니다.

사전 요구 사항

-

정규화된

.apps하위 도메인 및 해당 개인 키에 맞는 와일드카드 인증서가 있어야 합니다. 각각은 별도의 PEM 형식 파일이어야 합니다. - 개인 키는 암호화되지 않아야 합니다. 키가 암호화된 경우 OpenShift Container Platform으로 가져오기 전에 키의 암호를 해독합니다.

-

인증서에는

*.apps.<clustername>.<domain>을 표시하는subjectAltName확장자가 포함되어야 합니다. - 인증서 파일은 체인에 하나 이상의 인증서를 포함할 수 있습니다. 파일에는 와일드카드 인증서를 첫 번째 인증서로 나열하고, 그 다음에 다른 중간 인증서, 마지막으로 루트 CA 인증서를 나열해야 합니다.

- 루트 CA 인증서를 추가 PEM 형식 파일로 복사합니다.

-

-----END CERTIFICATE-----를포함하는 모든 인증서가 해당 줄 뒤에 캐리지 리턴 하나로 끝나는지 확인하세요.

프로세스

와일드카드 인증서에 서명하는 데 사용된 루트 CA 인증서만 포함하는 구성 맵을 생성합니다.

$ oc create configmap custom-ca \ --from-file=ca-bundle.crt=</path/to/example-ca.crt> \1 -n openshift-config- 1

</path/to/example-ca.crt>는 로컬 파일 시스템에서 루트 CA 인증서 파일의 경로입니다. 예를 들어,/etc/pki/ca-trust/source/anchors.

새로 생성된 구성 맵으로 클러스터 전체 프록시 구성을 업데이트합니다.

$ oc patch proxy/cluster \ --type=merge \ --patch='{"spec":{"trustedCA":{"name":"custom-ca"}}}'참고클러스터의 신뢰할 수 있는 CA만 업데이트하는 경우 MCO가

/etc/pki/ca-trust/source/anchors/openshift-config-user-ca-bundle.crt파일을 업데이트하고 MCC(Machine Config Controller)가 각 노드에 신뢰할 수 있는 CA 업데이트를 적용하므로 노드 재부팅이 필요하지 않습니다. 하지만 이러한 변경 사항으로 인해 MCD(Machine Config Daemon)는 kubelet 및 CRI-O와 같은 각 노드의 중요 서비스를 다시 시작합니다. 이러한 서비스 재시작으로 인해 각 노드는 서비스가 완전히 재시작될 때까지 잠시NotReady상태로 전환됩니다.openshift-config-user-ca-bundle.crt파일에서noproxy와 같은 다른 매개변수를 변경하면 MCO는 클러스터의 각 노드를 재부팅합니다.와일드카드 인증서 체인과 키를 포함하는 보안을 생성합니다.

$ oc create secret tls <secret> \1 --cert=</path/to/cert.crt> \2 --key=</path/to/cert.key> \3 -n openshift-ingress새로 생성된 보안으로 Ingress Controller 구성을 업데이트합니다.

$ oc patch ingresscontroller.operator default \ --type=merge -p \ '{"spec":{"defaultCertificate": {"name": "<secret>"}}}' \1 -n openshift-ingress-operator- 1

<secret>을 이전 단계에서 보안에 사용된 이름으로 교체합니다.

중요Ingress Operator가 롤링 업데이트를 수행하도록 하려면 비밀 이름을 업데이트해야 합니다. kubelet은 볼륨 마운트의 비밀에 대한 변경 사항을 자동으로 전파하므로 비밀 내용을 업데이트해도 롤링 업데이트가 트리거되지 않습니다. 자세한 내용은 Red Hat Knowledgebase 문서를 참조하십시오.

3.2. API 서버 인증서 추가

기본 API 서버 인증서는 내부 OpenShift Container Platform 클러스터 CA에서 발급합니다. 클러스터 외부의 클라이언트는 기본적으로 API 서버의 인증서를 확인할 수 없습니다. 이 인증서는 클라이언트가 신뢰하는 CA에서 발급한 인증서로 교체할 수 있습니다.

호스팅된 제어 평면 클러스터에서는 필요한 만큼 많은 사용자 정의 인증서를 Kubernetes API 서버에 추가할 수 있습니다. 하지만 작업자 노드가 제어 평면과 통신하는 데 사용하는 엔드포인트에 대한 인증서는 추가하지 마세요. 자세한 내용은 호스팅된 클러스터에서 사용자 지정 API 서버 인증서 구성을 참조하세요.

3.2.1. certificate이라는 API 서버 추가

기본 API 서버 인증서는 내부 OpenShift Container Platform 클러스터 CA에서 발급합니다. 리버스 프록시 또는 로드 밸런서가 사용되는 경우와 같이 클라이언트가 요청한 정규화된 도메인 이름(FQDN)을 기반으로 API 서버가 반환할 대체 인증서를 하나 이상 추가할 수 있습니다.

사전 요구 사항

- FQDN의 인증서와 해당 개인 키가 있어야 합니다. 각각은 별도의 PEM 형식 파일이어야 합니다.

- 개인 키는 암호화되지 않아야 합니다. 키가 암호화된 경우 OpenShift Container Platform으로 가져오기 전에 키의 암호를 해독합니다.

-

인증서에는 FQDN을 표시하는

subjectAltName확장자가 포함되어야 합니다. - 인증서 파일은 체인에 하나 이상의 인증서를 포함할 수 있습니다. API 서버 FQDN의 인증서는 파일의 첫 번째 인증서여야 합니다. 그런 다음 중간 인증서가 올 수 있으며 파일은 루트 CA 인증서로 끝나야 합니다.

내부 로드 밸런서용으로 이름 지정된 인증서를 제공하지 마십시오(host name api-int.<cluster_name>.<base_domain>). 그렇지 않으면 클러스터 성능이 저하됩니다.

프로세스

kubeadmin사용자로 새 API에 로그인합니다.$ oc login -u kubeadmin -p <password> https://FQDN:6443kubeconfig파일을 가져옵니다.$ oc config view --flatten > kubeconfig-newapiopenshift-config네임스페이스에 인증서 체인과 개인 키가 포함된 보안을 생성합니다.$ oc create secret tls <secret> \1 --cert=</path/to/cert.crt> \2 --key=</path/to/cert.key> \3 -n openshift-config생성된 보안을 참조하도록 API 서버를 업데이트합니다.

$ oc patch apiserver cluster \ --type=merge -p \ '{"spec":{"servingCerts": {"namedCertificates": \ [{"names": ["<FQDN>"], \1 "servingCertificate": {"name": "<secret>"}}]}}}'2 apiserver/cluster오브젝트를 조사하고 보안이 이제 참조되는지 확인합니다.$ oc get apiserver cluster -o yaml출력 예

... spec: servingCerts: namedCertificates: - names: - <FQDN> servingCertificate: name: <secret> ...kube-apiserver운영자를 확인하고 Kubernetes API 서버의 새 버전이 롤아웃되는지 확인합니다. 운영자가 구성 변경 사항을 탐지하고 새 배포를 트리거하는 데 1분 정도 걸릴 수 있습니다. 새 버전이 롤아웃되는 동안PROGRESSING은True를 보고합니다.$ oc get clusteroperators kube-apiserver다음 출력에 표시된 것처럼

PROGRESSING이False로 표시될 때까지 다음 단계를 진행하지 마십시오.출력 예

NAME VERSION AVAILABLE PROGRESSING DEGRADED SINCE kube-apiserver 4.19.0 True False False 145mPROGRESSING에True가 표시되면 몇 분 기다렸다가 다시 시도하십시오.참고Kubernetes API 서버의 새로운 개정판은 certificate라는 이름의 API 서버가 처음으로 추가된 경우에만 출시됩니다. API 서버 이름이 인증서로 갱신되면

kube-apiserver포드가 업데이트된 인증서를 동적으로 다시 로드하기 때문에 Kubernetes API 서버의 새로운 개정판이 롤아웃되지 않습니다.

3.3. 서비스 제공 인증서 보안을 사용하여 서비스 트래픽 보안

3.3.1. 서비스 제공 인증서 이해

서비스 제공 인증서는 암호화가 필요한 복잡한 미들웨어 애플리케이션을 지원하기 위한 것입니다. 이러한 인증서는 TLS 웹 서버 인증서로 발급됩니다.

service-ca 컨트롤러에서는 x509.SHA256WithRSA 서명 알고리즘을 사용하여 서비스 인증서를 생성합니다.

생성된 인증서 및 키는 PEM 형식이며, 생성된 보안의 tls.crt 및 tls.key에 각각 저장됩니다. 인증서와 키는 만료 시기가 다가오면 자동으로 교체됩니다.

서비스 인증서를 발급하는 서비스 CA 인증서는 26개월 동안 유효하며 유효 기간이 13개월 미만으로 남아 있으면 자동으로 순환됩니다. 교체 후에도 이전 서비스 CA 구성은 만료될 때까지 계속 신뢰 상태가 유지됩니다. 그러면 만료되기 전에 유예 기간 동안 영향을 받는 모든 서비스의 주요 자료를 새로 고칠 수 있습니다. 서비스를 다시 시작하고 키 자료를 새로 고치는 이 유예 기간 동안 클러스터를 업그레이드하지 않으면 이전 서비스 CA가 만료된 후 실패하지 않도록 서비스를 직접 다시 시작해야 할 수도 있습니다.

다음 명령을 사용하여 클러스터의 모든 Pod를 직접 다시 시작할 수 있습니다. 이 명령을 실행하면 모든 네임스페이스에서 실행 중인 모든 Pod가 삭제되므로 서비스가 중단됩니다. 이 Pod는 삭제 후 자동으로 다시 시작됩니다.

$ for I in $(oc get ns -o jsonpath='{range .items[*]} {.metadata.name}{"\n"} {end}'); \

do oc delete pods --all -n $I; \

sleep 1; \

done3.3.2. 서비스 인증서 추가

서비스와의 통신을 보호하려면 서명된 제공 인증서와 키 쌍을 서비스와 동일한 네임스페이스의 보안에 생성합니다.

생성된 인증서는 내부 서비스 DNS 이름 <service.name>.<service.namespace>.svc에만 유효하고 내부 통신에만 유효합니다. 서비스가 헤드리스 서비스(clusterIP 값이 설정되지 않음)인 경우 생성된 인증서에는 *.<service.name>.<service.namespace>.svc 형식의 와일드카드 제목도 포함됩니다.

생성된 인증서에는 헤드리스 서비스에 대한 와일드카드 제목이 포함되어 있으므로 클라이언트가 개별 Pod를 구분해야 하는 경우 서비스 CA를 사용하지 않아야 합니다. 이 경우 다음을 수행합니다.

- 다른 CA를 사용하여 개별 TLS 인증서를 생성합니다.

- 개별 Pod로 전달되며 다른 Pod로 가장해서는 안 되는 연결에 대해 서비스 CA를 신뢰할 수 있는 CA로 수락하지 마십시오. 이러한 연결은 개별 TLS 인증서를 생성하는 데 사용된 CA를 신뢰하도록 구성해야 합니다.

사전 요구 사항

- 서비스가 정의되어 있어야 합니다.

프로세스

service.beta.openshift.io/serving-cert-secret-name으로 서비스에 주석을 답니다.$ oc annotate service <service_name> \1 service.beta.openshift.io/serving-cert-secret-name=<secret_name>2 예를 들어 서비스

test1에 주석을 달려면 다음 명령을 사용합니다.$ oc annotate service test1 service.beta.openshift.io/serving-cert-secret-name=test1서비스를 검사하여 주석이 있는지 확인합니다.

$ oc describe service <service_name>출력 예

... Annotations: service.beta.openshift.io/serving-cert-secret-name: <service_name> service.beta.openshift.io/serving-cert-signed-by: openshift-service-serving-signer@1556850837 ...-

클러스터에서 서비스 보안을 생성하면

Pod사양에서 보안을 마운트하고, 사용 가능 상태가 되면 Pod에서 실행합니다.

3.3.3. 구성 맵에 서비스 CA 번들 추가

포드는 service.beta.openshift.io/inject-cabundle=true 주석이 있는 ConfigMap 객체를 마운트하여 서비스 인증 기관(CA) 인증서에 액세스할 수 있습니다. 구성 맵에 주석을 추가한 후 클러스터는 자동으로 서비스 CA 인증서를 구성 맵의 service-ca.crt 키에 삽입합니다. 이 CA 인증서에 액세스하면 TLS 클라이언트가 서비스 제공 인증서를 사용하여 서비스에 대한 연결을 확인할 수 있습니다.

이 주석을 구성 맵에 추가하면 OpenShift 서비스 CA 운영자가 구성 맵의 모든 데이터를 삭제합니다. Pod 구성을 저장하는 동일한 구성 맵을 사용하는 대신, service-ca.crt를 포함하는 별도의 구성 맵을 사용하는 것을 고려하세요.

프로세스

다음 명령을 입력하여

service.beta.openshift.io/inject-cabundle=true주석으로 구성 맵에 주석을 추가합니다.$ oc annotate configmap <config_map_name> \1 service.beta.openshift.io/inject-cabundle=true- 1

<config_map_name>을 주석을 달 구성 맵 이름으로 교체합니다.

참고볼륨 마운트 시

service-ca.crt키를 명시적으로 참조하면 CA 번들로 구성 맵을 삽입할 때까지 Pod가 시작되지 않습니다. 볼륨의 제공 인증서 구성에서선택적매개변수를true로 설정하면 이 동작을 재정의할 수 있습니다.구성 맵을 보고 서비스 CA 번들이 삽입되었는지 확인합니다.

$ oc get configmap <config_map_name> -o yamlCA 번들은 YAML 출력에서

service-ca.crt키 값으로 표시됩니다.apiVersion: v1 data: service-ca.crt: | -----BEGIN CERTIFICATE----- ...배포객체를 구성하여 포드에 있는 각 컨테이너에 볼륨으로 구성 맵을 마운트합니다.마운트된 구성 맵에 대한 볼륨을 정의하는 배포 개체 예제

apiVersion: apps/v1 kind: Deployment metadata: name: my-example-custom-ca-deployment namespace: my-example-custom-ca-ns spec: ... spec: ... containers: - name: my-container-that-needs-custom-ca volumeMounts: - name: trusted-ca mountPath: /etc/pki/ca-trust/extracted/pem readOnly: true volumes: - name: trusted-ca configMap: name: <config_map_name>1 items: - key: ca-bundle.crt2 path: tls-ca-bundle.pem3 # ...

3.3.4. API 서비스에 서비스 CA 번들 추가

spec.caBundle 필드에 서비스 CA 번들이 입력되도록 service.beta.openshift.io/inject-cabundle=true로 APIService 오브젝트에 주석을 답니다. 그러면 쿠버네티스 API 서버가 대상 끝점을 보호하는 데 사용되는 서비스 CA 인증서의 유효성을 확인할 수 있습니다.

프로세스

service.beta.openshift.io/inject-cabundle=true로 API 서비스에 주석을 답니다.$ oc annotate apiservice <api_service_name> \1 service.beta.openshift.io/inject-cabundle=true- 1

<api_service_name>을 주석을 달 API 서비스 이름으로 교체합니다.

예를 들어 API 서비스

test1에 주석을 달려면 다음 명령을 사용합니다.$ oc annotate apiservice test1 service.beta.openshift.io/inject-cabundle=trueAPI 서비스를 보고 서비스 CA 번들이 삽입되었는지 확인합니다.

$ oc get apiservice <api_service_name> -o yamlCA 번들은 YAML 출력의

spec.caBundle필드에 표시됩니다.apiVersion: apiregistration.k8s.io/v1 kind: APIService metadata: annotations: service.beta.openshift.io/inject-cabundle: "true" ... spec: caBundle: <CA_BUNDLE> ...

3.3.5. 사용자 정의 리소스 정의에 서비스 CA 번들 추가

spec.conversion.webhook.clientConfig.caBundle 필드에 서비스 CA 번들이 입력되도록 CustomResourceDefinition(CRD) 오브젝트에 service.beta.openshift.io/inject-cabundle=true로 주석을 답니다. 그러면 쿠버네티스 API 서버가 대상 끝점을 보호하는 데 사용되는 서비스 CA 인증서의 유효성을 확인할 수 있습니다.

CRD가 변환에 웹 후크를 사용하도록 구성된 경우 서비스 CA 번들은 CRD에만 삽입됩니다. CRD의 웹 후크가 서비스 CA 인증서로 보안된 경우에만 서비스 CA 번들을 삽입하는 것이 유용합니다.

프로세스

service.beta.openshift.io/inject-cabundle=true로 CRD에 주석을 답니다.$ oc annotate crd <crd_name> \1 service.beta.openshift.io/inject-cabundle=true- 1

<crd_name>을 주석을 달 CRD 이름으로 교체합니다.

예를 들어 CRD

test1에 주석을 달려면 다음 명령을 사용합니다.$ oc annotate crd test1 service.beta.openshift.io/inject-cabundle=trueCRD를 보고 서비스 CA 번들이 삽입되었는지 확인합니다.

$ oc get crd <crd_name> -o yamlCA 번들은 YAML 출력의

spec.conversion.webhook.clientConfig.caBundle필드에 표시됩니다.apiVersion: apiextensions.k8s.io/v1 kind: CustomResourceDefinition metadata: annotations: service.beta.openshift.io/inject-cabundle: "true" ... spec: conversion: strategy: Webhook webhook: clientConfig: caBundle: <CA_BUNDLE> ...

3.3.6. 변경 웹 후크 구성에 서비스 CA 번들 추가

각 웹 후크의 clientConfig.caBundle 필드에 서비스 CA 번들이 입력되도록 service.beta.openshift.io/inject-cabundle=true로 MutatingWebhookConfiguration 오브젝트에 주석을 달 수 있습니다. 그러면 쿠버네티스 API 서버가 대상 끝점을 보호하는 데 사용되는 서비스 CA 인증서의 유효성을 확인할 수 있습니다.

웹 후크마다 다른 CA 번들을 지정해야 하는 승인 웹 후크 구성에는 이 주석을 설정하지 마십시오. 그러면 모든 웹 후크에 서비스 CA 번들이 삽입됩니다.

프로세스

service.beta.openshift.io/inject-cabundle=true로 변경 웹 후크 구성에 주석을 답니다.$ oc annotate mutatingwebhookconfigurations <mutating_webhook_name> \1 service.beta.openshift.io/inject-cabundle=true- 1

<mutating_webhook_name>을 주석을 달 변경 웹 후크 구성 이름으로 교체합니다.

예를 들어 변경 웹 후크 구성

test1에 주석을 달려면 다음 명령을 사용합니다.$ oc annotate mutatingwebhookconfigurations test1 service.beta.openshift.io/inject-cabundle=true변경 웹 후크 구성을 보고 서비스 CA 번들이 삽입되었는지 확인합니다.

$ oc get mutatingwebhookconfigurations <mutating_webhook_name> -o yamlCA 번들은 YAML 출력에 있는 모든 웹 후크의

clientConfig.caBundle필드에 표시됩니다.apiVersion: admissionregistration.k8s.io/v1 kind: MutatingWebhookConfiguration metadata: annotations: service.beta.openshift.io/inject-cabundle: "true" ... webhooks: - myWebhook: - v1beta1 clientConfig: caBundle: <CA_BUNDLE> ...

3.3.7. 검증 웹 후크 구성에 서비스 CA 번들 추가

각 웹 후크의 clientConfig.caBundle 필드에 서비스 CA 번들이 입력되도록 service.beta.openshift.io/inject-cabundle=true로 ValidatingWebhookConfiguration 오브젝트에 주석을 달 수 있습니다. 그러면 쿠버네티스 API 서버가 대상 끝점을 보호하는 데 사용되는 서비스 CA 인증서의 유효성을 확인할 수 있습니다.

웹 후크마다 다른 CA 번들을 지정해야 하는 승인 웹 후크 구성에는 이 주석을 설정하지 마십시오. 그러면 모든 웹 후크에 서비스 CA 번들이 삽입됩니다.

프로세스

service.beta.openshift.io/inject-cabundle=true로 검증 웹 후크 구성에 주석을 답니다.$ oc annotate validatingwebhookconfigurations <validating_webhook_name> \1 service.beta.openshift.io/inject-cabundle=true- 1

<validating_webhook_name>을 주석을 달 검증 웹 후크 구성 이름으로 교체합니다.

예를 들어 검증 웹 후크 구성

test1에 주석을 달려면 다음 명령을 사용합니다.$ oc annotate validatingwebhookconfigurations test1 service.beta.openshift.io/inject-cabundle=true검증 웹 후크 구성을 보고 서비스 CA 번들이 삽입되었는지 확인합니다.

$ oc get validatingwebhookconfigurations <validating_webhook_name> -o yamlCA 번들은 YAML 출력에 있는 모든 웹 후크의

clientConfig.caBundle필드에 표시됩니다.apiVersion: admissionregistration.k8s.io/v1 kind: ValidatingWebhookConfiguration metadata: annotations: service.beta.openshift.io/inject-cabundle: "true" ... webhooks: - myWebhook: - v1beta1 clientConfig: caBundle: <CA_BUNDLE> ...

3.3.8. 생성된 서비스 인증서를 직접 순환

관련 보안을 삭제하여 서비스 인증서를 순환할 수 있습니다. 보안을 삭제하면 새로운 보안이 자동으로 생성되어 새 인증서가 생성됩니다.

사전 요구 사항

- 인증서 및 키 쌍을 포함하는 보안이 서비스용으로 생성되어야 합니다.

프로세스

서비스를 검사하여 인증서가 포함된 보안을 판별합니다. 아래 표시된 대로

serving-cert-secret-name주석에 있습니다.$ oc describe service <service_name>출력 예

... service.beta.openshift.io/serving-cert-secret-name: <secret> ...서비스용으로 생성된 보안을 삭제합니다. 이 프로세스는 자동으로 보안을 재생성합니다.

$ oc delete secret <secret>1 - 1

<secret>을 이전 단계의 보안 이름으로 교체합니다.

새 보안을 확보하고

AGE를 검사하여 인증서가 다시 생성되었는지 확인합니다.$ oc get secret <service_name>출력 예

NAME TYPE DATA AGE <service.name> kubernetes.io/tls 2 1s

3.3.9. 서비스 CA 인증서를 직접 순환

서비스 CA는 26개월 동안 유효하며 유효 기간이 13개월 미만으로 남아 있으면 자동으로 새로 고쳐집니다.

필요하면 다음 절차에 따라 서비스 CA를 직접 새로 고칠 수 있습니다.

수동으로 순환된 서비스 CA는 이전 서비스 CA와의 신뢰를 유지 관리하지 않습니다. 클러스터의 Pod가 다시 시작되어 Pod가 새 서비스 CA에서 발급한 서비스 제공 인증서를 사용하고 있는지 확인할 때까지 일시적으로 서비스 중단이 발생할 수 있습니다.

사전 요구 사항

- 클러스터 관리자로 로그인해야 합니다.

프로세스

다음 명령을 사용하여 현재 서비스 CA 인증서의 만료 날짜를 봅니다.

$ oc get secrets/signing-key -n openshift-service-ca \ -o template='{{index .data "tls.crt"}}' \ | base64 --decode \ | openssl x509 -noout -enddate서비스 CA를 직접 순환합니다. 이 프로세스는 새로운 서비스 인증서에 서명하는 데 사용될 새로운 서비스 CA를 생성합니다.

$ oc delete secret/signing-key -n openshift-service-ca새 인증서를 모든 서비스에 적용하도록 클러스터의 모든 Pod를 다시 시작합니다. 이 명령을 실행하면 모든 서비스가 업데이트된 인증서를 사용합니다.

$ for I in $(oc get ns -o jsonpath='{range .items[*]} {.metadata.name}{"\n"} {end}'); \ do oc delete pods --all -n $I; \ sleep 1; \ done주의이 명령은 모든 네임스페이스에서 실행 중인 모든 Pod를 대상으로 진행하고 삭제하므로 서비스가 중단됩니다. 이 Pod는 삭제 후 자동으로 다시 시작됩니다.

3.4. CA 번들 업데이트

3.4.1. CA 번들 인증서 이해

프록시 인증서를 사용하면 송신 연결을 만들 때 플랫폼 구성요소에서 사용하는 하나 이상의 사용자 정의 인증 기관(CA) 인증서를 지정할 수 있습니다.

Proxy 오브젝트의 trustedCA 필드는 사용자 제공 신뢰할 수 있는 인증 기관(CA) 번들을 포함하는 구성 맵에 대한 참조입니다. 이 번들은 RHCOS(Red Hat Enterprise Linux CoreOS) 신뢰 번들과 병합되어 송신 HTTPS 호출을 수행하는 플랫폼 구성요소의 신뢰 저장소에 삽입됩니다. 예를 들어 image-registry-operator에서 이미지를 다운로드하도록 외부 이미지 레지스트리를 호출합니다. trustedCA를 지정하지 않으면 프록시 HTTPS 연결에 RHCOS 신뢰 번들만 사용됩니다. 자체 인증서 인프라를 사용하려면 RHCOS 신뢰 번들에 사용자 정의 CA 인증서를 제공합니다.

trustedCA 필드는 프록시 유효성 검증기만 사용해야 합니다. 유효성 검증기를 통해서는 필수 키 ca-bundle.crt에서 인증서 번들을 읽고 openshift-config-managed 네임스페이스의 trusted-ca-bundle이라는 구성 맵에 복사해야 합니다. trustedCA에서 참조하는 구성 맵의 네임스페이스는 openshift-config입니다.

apiVersion: v1

kind: ConfigMap

metadata:

name: user-ca-bundle

namespace: openshift-config

data:

ca-bundle.crt: |

-----BEGIN CERTIFICATE-----

Custom CA certificate bundle.

-----END CERTIFICATE-----3.4.2. CA 번들 인증서 교체

프로세스

와일드카드 인증서에 서명하는 데 사용된 루트 CA 인증서만 포함하는 구성 맵을 생성합니다.

$ oc create configmap custom-ca \ --from-file=ca-bundle.crt=</path/to/example-ca.crt> \1 -n openshift-config- 1

</path/to/example-ca.crt>는로컬 파일 시스템의 CA 인증서 번들에 대한 경로입니다.

새로 생성된 구성 맵으로 클러스터 전체 프록시 구성을 업데이트합니다.

$ oc patch proxy/cluster \ --type=merge \ --patch='{"spec":{"trustedCA":{"name":"custom-ca"}}}'

4장. 인증서 유형 및 설명

4.1. API 서버의 사용자 제공 인증서

4.1.1. 목적

API 서버는 api.<cluster_name>.<base_domain>에서 클러스터 외부의 클라이언트가 액세스할 수 있습니다. 클라이언트가 다른 호스트 이름으로 또는 클러스터 관리 인증 기관(CA) 인증서를 클라이언트에 배포하지 않고 API 서버에 액세스하게 합니다. 관리자는 콘텐츠를 제공할 때 API 서버가 사용할 사용자 정의 기본 인증서를 설정해야 합니다.

4.1.2. 위치

사용자 제공 인증서는 openshift-config 네임스페이스에 kubernetes.io/tls 유형 Secret으로 제공되어야 합니다. API 서버 클러스터 구성인 apiserver/cluster 리소스를 업데이트하여 사용자 제공 인증서를 사용할 수 있게 합니다.

4.1.3. 관리

사용자 제공 인증서는 사용자가 관리합니다.

4.1.4. 만료

API 서버 클라이언트 인증서가 5분 내에 만료됩니다.

사용자 제공 인증서는 사용자가 관리합니다.

4.1.5. 사용자 정의

필요에 따라 사용자 관리 인증서가 포함된 보안을 업데이트합니다.

4.2. 프록시 인증서

4.2.1. 목적

프록시 인증서를 사용하면 송신 연결을 만들 때 플랫폼 구성요소에서 사용하는 하나 이상의 사용자 정의 인증 기관(CA) 인증서를 지정할 수 있습니다.

Proxy 오브젝트의 trustedCA 필드는 사용자 제공 신뢰할 수 있는 인증 기관(CA) 번들을 포함하는 구성 맵에 대한 참조입니다. 이 번들은 RHCOS(Red Hat Enterprise Linux CoreOS) 신뢰 번들과 병합되어 송신 HTTPS 호출을 수행하는 플랫폼 구성요소의 신뢰 저장소에 삽입됩니다. 예를 들어 image-registry-operator에서 이미지를 다운로드하도록 외부 이미지 레지스트리를 호출합니다. trustedCA를 지정하지 않으면 프록시 HTTPS 연결에 RHCOS 신뢰 번들만 사용됩니다. 자체 인증서 인프라를 사용하려면 RHCOS 신뢰 번들에 사용자 정의 CA 인증서를 제공합니다.

trustedCA 필드는 프록시 유효성 검증기만 사용해야 합니다. 유효성 검증기를 통해서는 필수 키 ca-bundle.crt에서 인증서 번들을 읽고 openshift-config-managed 네임스페이스의 trusted-ca-bundle이라는 구성 맵에 복사해야 합니다. trustedCA에서 참조하는 구성 맵의 네임스페이스는 openshift-config입니다.

apiVersion: v1

kind: ConfigMap

metadata:

name: user-ca-bundle

namespace: openshift-config

data:

ca-bundle.crt: |

-----BEGIN CERTIFICATE-----

Custom CA certificate bundle.

-----END CERTIFICATE-----4.2.2. 설치 중 프록시 인증서 관리

설치 프로그램 구성의 additionalTrustBundle 값은 설치 중 프록시 신뢰 CA 인증서를 지정하는 데 사용됩니다. 예를 들면 다음과 같습니다.

$ cat install-config.yaml출력 예

...

proxy:

httpProxy: http://<username:password@proxy.example.com:123/>

httpsProxy: http://<username:password@proxy.example.com:123/>

noProxy: <123.example.com,10.88.0.0/16>

additionalTrustBundle: |

-----BEGIN CERTIFICATE-----

<MY_HTTPS_PROXY_TRUSTED_CA_CERT>

-----END CERTIFICATE-----

...4.2.3. 위치

사용자 제공 신뢰 번들은 구성 맵으로 표시됩니다. 구성 맵은 송신 HTTPS 호출을 수행하는 플랫폼 구성 요소의 파일 시스템에 마운트됩니다. 일반적으로 Operator는 구성 맵을 /etc/pki/ca-trust/extracted/pem/tls-ca-bundle.pem에 마운트하지만 프록시에는 필요하지 않습니다. 프록시는 HTTPS 연결을 수정하거나 검사할 수 있습니다. 두 경우 모두 프록시는 연결을 위해 새 인증서를 생성하고 서명해야 합니다.

완전한 프록시 지원이란 지정된 프록시에 연결하고 생성된 서명을 신뢰한다는 의미입니다. 따라서 사용자가 신뢰할 수 있는 루트를 지정하고 이 신뢰할 수 있는 루트에 연결된 인증서 체인도 신뢰할 수 있게 해야 합니다.

RHCOS 신뢰 번들을 사용하는 경우 /etc/pki/ca-trust/source/anchors에 CA 인증서를 둡니다. 자세한 내용은 Red Hat Enterprise Linux(RHEL) 네트워크 보안 문서에서 공유 시스템 인증서 사용을 참조하세요.

4.2.4. 만료

사용자가 사용자 제공 신뢰 번들의 만료 기간을 설정합니다.

기본 만료 기간은 CA 인증서 자체를 통해 정의됩니다. OpenShift Container Platform 또는 RHCOS에서 사용하기 전에 인증서에 맞게 기본 만료 기간을 구성하는 것은 CA 관리자의 책임입니다.

Red Hat에서는 CA 만료 시점을 모니터링하지 않습니다. 그러나 CA의 수명이 길기 때문에 일반적으로 문제가 되지 않습니다. 그러나 신뢰 번들을 정기적으로 업데이트해야 할 수도 있습니다.

4.2.5. 서비스

기본적으로 송신 HTTPS 호출을 수행하는 모든 플랫폼 구성요소에서는 RHCOS 신뢰 번들을 사용합니다. trustedCA가 정의된 경우에도 사용됩니다.

RHCOS 노드에서 실행 중인 모든 서비스는 노드의 신뢰 번들을 사용할 수 있습니다.

4.2.6. 관리

이러한 인증서는 사용자가 아닌 시스템에서 관리합니다.

4.2.7. 사용자 정의

사용자 제공 신뢰 번들 업데이트는 다음 중 하나로 구성됩니다.

-

trustedCA에서 참조하는 구성 맵에서 PEM 인코딩 인증서 업데이트 -

새 신뢰 번들이 포함된 네임스페이스

openshift-config에 구성 맵을 생성하고 새 구성 맵 이름을 참조하도록trustedCA업데이트

RHCOS 신뢰 번들에 CA 인증서를 작성하는 메커니즘은 다른 파일을 RHCOS에 작성하는 방법과 같습니다. 이 방법은 머신 구성을 사용하여 수행됩니다. 머신 구성 운영자(MCO)가 새로운 CA 인증서가 포함된 새로운 머신 구성을 적용하면, 나중에 update-ca-trust 프로그램을 실행하고 RHCOS 노드에서 CRI-O 서비스를 다시 시작합니다. 이번 업데이트에서는 노드를 재부팅할 필요가 없습니다. CRI-O 서비스를 다시 시작하면 신뢰 번들이 새 CA 인증서로 자동 업데이트됩니다. 예를 들면 다음과 같습니다.

apiVersion: machineconfiguration.openshift.io/v1

kind: MachineConfig

metadata:

labels:

machineconfiguration.openshift.io/role: worker

name: 50-examplecorp-ca-cert

spec:

config:

ignition:

version: 3.1.0

storage:

files:

- contents:

source: data:text/plain;charset=utf-8;base64,LS0tLS1CRUdJTiBDRVJUSUZJQ0FURS0tLS0tCk1JSUVORENDQXh5Z0F3SUJBZ0lKQU51bkkwRDY2MmNuTUEwR0NTcUdTSWIzRFFFQkN3VUFNSUdsTVFzd0NRWUQKV1FRR0V3SlZVekVYTUJVR0ExVUVDQXdPVG05eWRHZ2dRMkZ5YjJ4cGJtRXhFREFPQmdOVkJBY01CMUpoYkdWcApBMmd4RmpBVUJnTlZCQW9NRFZKbFpDQklZWFFzSUVsdVl5NHhFekFSQmdOVkJBc01DbEpsWkNCSVlYUWdTVlF4Ckh6QVpCZ05WQkFNTUVsSmxaQ0JJWVhRZ1NWUWdVbTl2ZENCRFFURWhNQjhHQ1NxR1NJYjNEUUVKQVJZU2FXNW0KWGpDQnBURUxNQWtHQTFVRUJoTUNWVk14RnpBVkJnTlZCQWdNRGs1dmNuUm9JRU5oY205c2FXNWhNUkF3RGdZRApXUVFIREFkU1lXeGxhV2RvTVJZd0ZBWURWUVFLREExU1pXUWdTR0YwTENCSmJtTXVNUk13RVFZRFZRUUxEQXBTCkFXUWdTR0YwSUVsVU1Sc3dHUVlEVlFRRERCSlNaV1FnU0dGMElFbFVJRkp2YjNRZ1EwRXhJVEFmQmdrcWhraUcKMHcwQkNRRVdFbWx1Wm05elpXTkFjbVZrYUdGMExtTnZiVENDQVNJd0RRWUpLb1pJaHZjTkFRRUJCUUFEZ2dFUApCRENDQVFvQ2dnRUJBTFF0OU9KUWg2R0M1TFQxZzgwcU5oMHU1MEJRNHNaL3laOGFFVHh0KzVsblBWWDZNSEt6CmQvaTdsRHFUZlRjZkxMMm55VUJkMmZRRGsxQjBmeHJza2hHSUlaM2lmUDFQczRsdFRrdjhoUlNvYjNWdE5xU28KSHhrS2Z2RDJQS2pUUHhEUFdZeXJ1eTlpckxaaW9NZmZpM2kvZ0N1dDBaV3RBeU8zTVZINXFXRi9lbkt3Z1BFUwpZOXBvK1RkQ3ZSQi9SVU9iQmFNNzYxRWNyTFNNMUdxSE51ZVNmcW5obzNBakxRNmRCblBXbG82MzhabTFWZWJLCkNFTHloa0xXTVNGa0t3RG1uZTBqUTAyWTRnMDc1dkNLdkNzQ0F3RUFBYU5qTUdFd0hRWURWUjBPQkJZRUZIN1IKNXlDK1VlaElJUGV1TDhacXczUHpiZ2NaTUI4R0ExVWRJd1FZTUJhQUZIN1I0eUMrVWVoSUlQZXVMOFpxdzNQegpjZ2NaTUE4R0ExVWRFd0VCL3dRRk1BTUJBZjh3RGdZRFZSMFBBUUgvQkFRREFnR0dNQTBHQ1NxR1NJYjNEUUVCCkR3VUFBNElCQVFCRE52RDJWbTlzQTVBOUFsT0pSOCtlbjVYejloWGN4SkI1cGh4Y1pROGpGb0cwNFZzaHZkMGUKTUVuVXJNY2ZGZ0laNG5qTUtUUUNNNFpGVVBBaWV5THg0ZjUySHVEb3BwM2U1SnlJTWZXK0tGY05JcEt3Q3NhawpwU29LdElVT3NVSks3cUJWWnhjckl5ZVFWMnFjWU9lWmh0UzV3QnFJd09BaEZ3bENFVDdaZTU4UUhtUzQ4c2xqCjVlVGtSaml2QWxFeHJGektjbGpDNGF4S1Fsbk92VkF6eitHbTMyVTB4UEJGNEJ5ZVBWeENKVUh3MVRzeVRtZWwKU3hORXA3eUhvWGN3bitmWG5hK3Q1SldoMWd4VVp0eTMKLS0tLS1FTkQgQ0VSVElGSUNBVEUtLS0tLQo=

mode: 0644

overwrite: true

path: /etc/pki/ca-trust/source/anchors/examplecorp-ca.crt머신의 신뢰 저장소는 노드의 신뢰 저장소 업데이트도 지원해야 합니다.

4.2.8. 갱신

RHCOS 노드에서 인증서를 자동 갱신할 수 있는 Operator가 없습니다.

Red Hat에서는 CA 만료 시점을 모니터링하지 않습니다. 그러나 CA의 수명이 길기 때문에 일반적으로 문제가 되지 않습니다. 그러나 신뢰 번들을 정기적으로 업데이트해야 할 수도 있습니다.

4.3. 서비스 CA 인증서

4.3.1. 목적

service-ca는 OpenShift Container Platform 클러스터가 배포될 때 자체 서명된 CA를 만드는 Operator입니다.

4.3.2. 만료

사용자 정의 기간은 지원되지 않습니다. 자체 서명된 CA는 tls.crt(인증서), tls.key(개인 키) 및 ca-bundle.crt(CA 번들)의 규정된 이름 service-ca/signing-key로 보안에 저장됩니다.

다른 서비스에서는 service.beta.openshift.io/serving-cert-secret-name: <secret name>으로 서비스 리소스에 주석을 달아 서비스 제공 인증서를 요청할 수 있습니다. 이에 응답하여 Operator는 이름 지정된 보안에 대한 tls.crt로 새 인증서를, tls.key로 개인 키를 생성합니다. 이 인증서는 2년간 유효합니다.

다른 서비스에서는 서비스 CA에서 생성된 인증서의 검증을 지원하기 위해 service.beta.openshift.io/inject-cabundle: true로 주석을 달아 서비스 CA의 CA 번들을 API 서비스 또는 구성 맵 리소스에 삽입하도록 요청할 수 있습니다. 이에 응답하여 Operator는 현재 CA 번들을 API 서비스의 CABundle 필드에 쓰거나 service-ca.crt로 구성 맵에 씁니다.