此内容没有您所选择的语言版本。

Virtualization

OpenShift Virtualization installation and usage.

Abstract

Chapter 1. About

1.1. About OpenShift Virtualization

OpenShift Virtualization provides a comprehensive virtualization solution that allows you to run and manage virtual machine workloads alongside container workloads in your Red Hat OpenShift Service on AWS cluster.

1.1.1. What you can do with OpenShift Virtualization

OpenShift Virtualization provides the scalable, enterprise-grade virtualization functionality in Red Hat OpenShift. You can use it to manage virtual machines (VMs) exclusively or alongside container workloads.

OpenShift Virtualization adds new objects into your Red Hat OpenShift Service on AWS cluster by using Kubernetes custom resources to enable virtualization tasks. These tasks include:

- Creating and managing Linux and Windows VMs

- Running pod and VM workloads alongside each other in a cluster

- Connecting to VMs through a variety of consoles and CLI tools

- Importing and cloning existing VMs

- Managing network interface controllers and storage disks attached to VMs

- Live migrating VMs between nodes

OpenShift Virtualization on Red Hat OpenShift Service on AWS includes guest subscriptions for Red Hat Enterprise Linux (RHEL) based on the number of vCPUs on the host:

- Hosts with 96 or more vCPUs: Unlimited RHEL guest subscriptions are included.

Hosts with fewer than 96 vCPUs: You can run RHEL guests with a guest vCPU to host vCPU ratio of up to 8:1.

For example, a host with 64 vCPUs can run up to 512 RHEL guest vCPUs (64 host vCPUs x 8 = 512 guest vCPUs).

OVN-Kubernetes is the default network provider for OpenShift Virtualization on Red Hat OpenShift Service on AWS. For more information, see "OVN-Kubernetes" in the Additional resources.

You can manage your cluster and virtualization resources by using the Virtualization perspective of the Red Hat OpenShift Service on AWS web console, and by using the OpenShift CLI (oc).

You can check your OpenShift Virtualization cluster for compliance issues by installing the Compliance Operator and running a scan with the ocp4-moderate and ocp4-moderate-node profiles. The Compliance Operator uses OpenSCAP, a NIST-certified tool, to scan and enforce security policies.

For information about partnering with Independent Software Vendors (ISVs) and Services partners for specialized storage, networking, backup, and additional functionality, see the Red Hat Ecosystem Catalog.

If you are familiar with VMware vSphere, the following table lists OpenShift Virtualization components that you can use to accomplish similar tasks.

However, because OpenShift Virtualization is conceptually different from vSphere, and much of its functionality comes from the underlying Red Hat OpenShift Service on AWS, OpenShift Virtualization does not have direct alternatives for all vSphere concepts or components.

| vSphere concept | OpenShift Virtualization | Explanation |

|---|---|---|

| Datastore | Persistent volume (PV) Persistent volume claim (PVC) |

Stores VM disks. A PV represents existing storage and is attached to a VM through a PVC. When created with the |

| Dynamic Resource Scheduling (DRS) | Pod eviction policy Descheduler | Provides active resource balancing. A combination of pod eviction policies and a descheduler allows VMs to be live migrated to more appropriate nodes to keep node resource utilization manageable. |

| NSX | Multus OVN-Kubernetes Third-party container network interface (CNI) plug-ins | Provides an overlay network configuration. There is no direct equivalent for NSX in OpenShift Virtualization, but you can use the OVN-Kubernetes network provider or install certified third-party CNI plug-ins. |

| Storage Policy Based Management (SPBM) | Storage class | Provides policy-based storage selection. Storage classes represent various storage types and describe storage capabilities, such as quality of service, backup policy, reclaim policy, and whether volume expansion is allowed. A PVC can request a specific storage class to satisfy application requirements. |

| vCenter vRealize Operations | OpenShift Metrics and Monitoring | Provides host and VM metrics. You can view metrics and monitor the overall health of the cluster and VMs by using the Red Hat OpenShift Service on AWS web console. |

| vMotion | Live migration |

Moves a running VM to another node without interruption. For live migration to be available, the PVC attached to the VM must have the |

| vSwitch DvSwitch | NMState Operator Multus | Provides a physical network configuration. You can use the NMState Operator to apply state-driven network configuration and manage various network interface types, including Linux bridges and network bonds. With Multus, you can attach multiple network interfaces and connect VMs to external networks. |

OpenShift Virtualization 4.21 is supported for use on Red Hat OpenShift Service on AWS 4 clusters. To use the latest z-stream release of OpenShift Virtualization, you must first upgrade to the latest version of Red Hat OpenShift Service on AWS. The latest stable release of OpenShift Virtualization 4.21 is 4.21.8.

OpenShift Virtualization is currently available on x86-64 CPUs. Arm-based nodes are not yet supported.

If you use the storage API with known storage providers, the volume and access modes are selected automatically. However, if you use a storage class that does not have a storage profile, you must configure the volume and access mode.

For a list of known storage providers for OpenShift Virtualization, see the Red Hat Ecosystem Catalog.

For best results, use the ReadWriteMany (RWX) access mode and the Block volume mode. This is important for the following reasons:

-

ReadWriteMany(RWX) access mode is required for live migration. -

The

Blockvolume mode performs significantly better than theFilesystemvolume mode. This is because theFilesystemvolume mode uses more storage layers, including a file system layer and a disk image file. These layers are not necessary for VM disk storage.

You cannot live migrate virtual machines with the following configurations:

-

Storage volume with

ReadWriteOnce(RWO) access mode - Passthrough features such as GPUs

Set the evictionStrategy field to None for these virtual machines. The None strategy powers down VMs during node reboots.

1.2. Security policies

OpenShift Virtualization provides built-in security features and authorization policies to protect virtual machine workloads and ensure secure cluster operations across your environment.

Key points

-

OpenShift Virtualization adheres to the

restrictedKubernetes pod security standards profile, which aims to enforce the current best practices for pod security. - Virtual machine (VM) workloads run as unprivileged pods.

-

Security context constraints (SCCs) are defined for the

kubevirt-controllerservice account. For more information about SSCs, see "Additional resources". - TLS certificates for OpenShift Virtualization components are renewed and rotated automatically.

1.2.1. About workload security

By default, virtual machine (VM) workloads do not run with root privileges in OpenShift Virtualization, and there are no supported OpenShift Virtualization features that require root privileges.

For each VM, a virt-launcher pod runs an instance of libvirt in session mode to manage the VM process. In session mode, the libvirt daemon runs as a non-root user account and only permits connections from clients that are running under the same user identifier (UID). Therefore, VMs run as unprivileged pods, adhering to the security principle of least privilege.

1.2.2. TLS certificates

TLS certificates for OpenShift Virtualization components are renewed and rotated automatically. You are not required to refresh them manually.

1.2.2.1. Automatic renewal schedules

TLS certificates are automatically deleted and replaced according to the following schedule:

- KubeVirt certificates are renewed daily.

- Containerized Data Importer controller (CDI) certificates are renewed every 15 days.

- MAC pool certificates are renewed every year. Automatic TLS certificate rotation does not disrupt any operations. For example, the following operations continue to function without any disruption:

- Migrations

- Image uploads

- VNC and console connections

1.2.3. Authorization

OpenShift Virtualization uses role-based access control (RBAC) to define permissions for human users and service accounts. The permissions defined for service accounts control the actions that OpenShift Virtualization components can perform.

You can also use RBAC roles to manage user access to virtualization features. For example, an administrator can create an RBAC role that provides the permissions required to launch a virtual machine. The administrator can then restrict access by binding the role to specific users.

By using cluster role aggregation, OpenShift Virtualization extends the default Red Hat OpenShift Service on AWS cluster roles to include permissions for accessing virtualization objects. Roles unique to OpenShift Virtualization are not aggregated with Red Hat OpenShift Service on AWS roles.

| Default cluster role | OpenShift Virtualization cluster role | OpenShift Virtualization cluster role description |

|---|---|---|

|

|

| A user that can view all OpenShift Virtualization resources in the cluster but cannot create, delete, modify, or access them. For example, the user can see that a virtual machine (VM) is running but cannot shut it down or gain access to its console. |

|

|

| A user that can modify all OpenShift Virtualization resources in the cluster. For example, the user can create VMs, access VM consoles, and delete VMs. |

|

|

|

A user that has full permissions to all OpenShift Virtualization resources, including the ability to delete collections of resources. The user can also view and modify the OpenShift Virtualization runtime configuration, which is located in the |

|

|

|

A user that can create, delete, and update VM live migration requests, which are represented by namespaced |

The following permissions are granted to the Containerized Data Importer (CDI), including the cdi-operator and cdi-controller service accounts.

1.2.3.2.1. Cluster-wide RBAC roles

| CDI cluster role | Resources | Verbs |

|---|---|---|

|

|

|

|

|

|

| |

|

|

|

|

|

|

| |

|

|

|

|

|

|

| |

|

|

|

|

| API group | Resources | Verbs |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Allow list: |

|

|

|

Allow list: |

|

|

|

|

|

| API group | Resources | Verbs |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1.2.3.2.2. Namespaced RBAC roles

| API group | Resources | Verbs |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| API group | Resources | Verbs |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Security context constraints (SCCs) control permissions for pods. These permissions include actions that a pod, a collection of containers, can perform and what resources it can access. You can use SCCs to define a set of conditions that a pod must run with to be accepted into the system.

The virt-controller is a cluster controller that creates the virt-launcher pods for virtual machines in the cluster.

By default, virt-launcher pods run with the default service account in the namespace. If your compliance controls require a unique service account, assign one to the VM. The setting applies to the VirtualMachineInstance object and the virt-launcher pod.

The kubevirt-controller service account is granted additional SCCs and Linux capabilities so that it can create virt-launcher pods with the appropriate permissions. These extended permissions allow virtual machines to use OpenShift Virtualization features that are beyond the scope of typical pods.

The kubevirt-controller service account is granted the following SCCs:

scc.AllowHostDirVolumePlugin = true- This allows virtual machines to use the hostpath volume plugin.

scc.AllowPrivilegedContainer = false-

This ensures the

virt-launcherpod is not run as a privileged container. scc.AllowedCapabilities = []corev1.Capability{"SYS_NICE", "NET_BIND_SERVICE"}-

SYS_NICEallows setting the CPU affinity. -

NET_BIND_SERVICEallows DHCP and Slirp operations.

-

You can view the SecurityContextConstraints definition for the kubevirt-controller by using the oc tool:

$ oc get scc kubevirt-controller -o yaml

You can view the RBAC definition for the kubevirt-controller clusterrole by using the oc tool:

$ oc get clusterrole kubevirt-controller -o yaml1.3. OpenShift Virtualization Architecture

OpenShift Virtualization architecture consists of several Operators and components that manage the lifecycle, storage, networking, and scheduling of virtual machine workloads within the cluster.

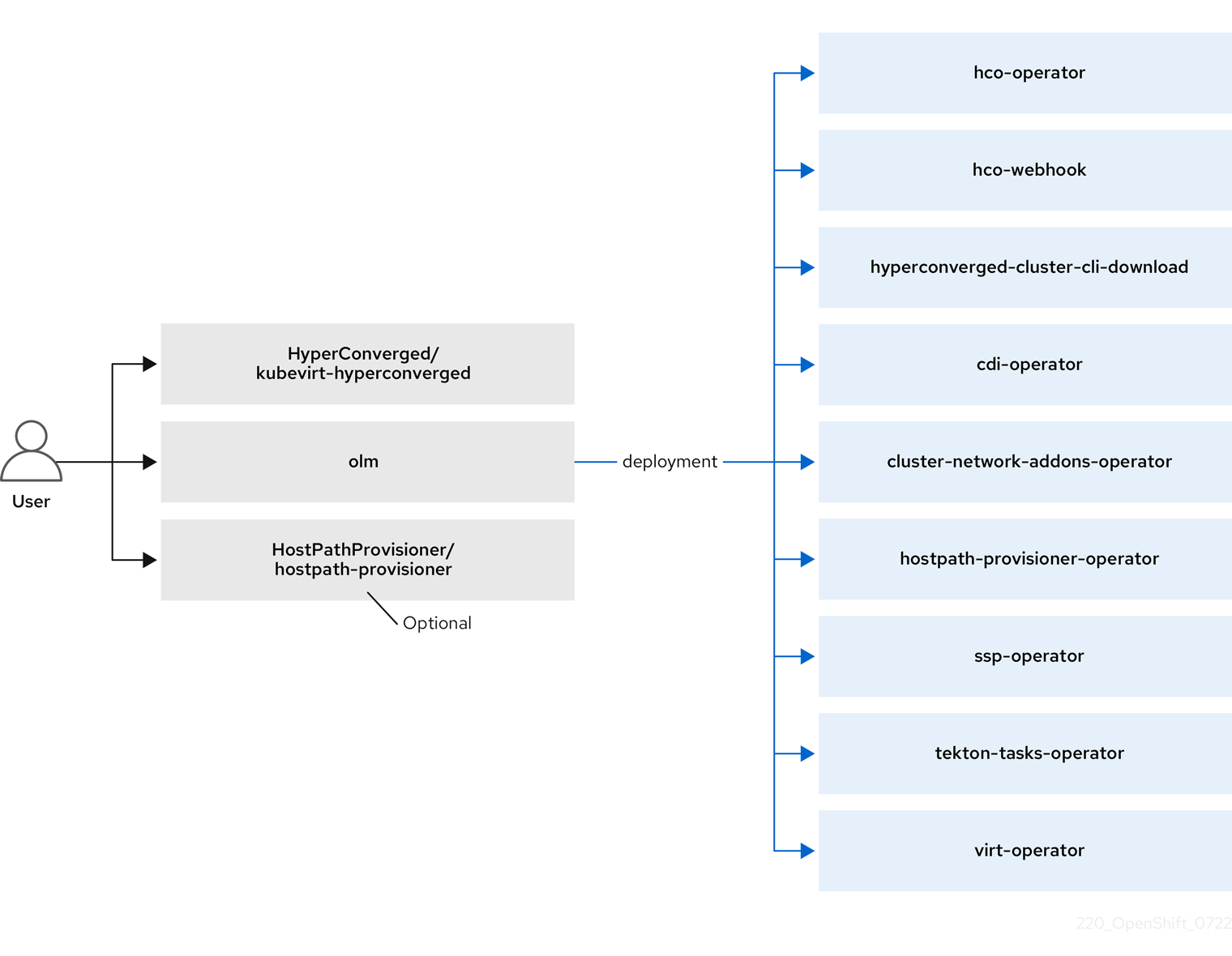

The Operator Lifecycle Manager (OLM) deploys operator pods for each component of OpenShift Virtualization:

-

Compute:

virt-operator -

Storage:

cdi-operator -

Network:

cluster-network-addons-operator -

Scaling:

ssp-operator

OLM also deploys the hyperconverged-cluster-operator pod, which is responsible for the deployment, configuration, and life cycle of other components, and several helper pods: hco-webhook, and hyperconverged-cluster-cli-download.

After all operator pods are successfully deployed, you should create the HyperConverged custom resource (CR). The configurations set in the HyperConverged CR serve as the single source of truth and the entrypoint for OpenShift Virtualization, and guide the behavior of the CRs.

The HyperConverged CR creates corresponding CRs for the operators of all other components within its reconciliation loop. Each operator then creates resources such as daemon sets, config maps, and additional components for the OpenShift Virtualization control plane. For example, when the HyperConverged Operator (HCO) creates the KubeVirt CR, the OpenShift Virtualization Operator reconciles it and creates additional resources such as virt-controller, virt-handler, and virt-api.

The OLM deploys the Hostpath Provisioner (HPP) Operator, but it is not functional until you create a hostpath-provisioner CR.

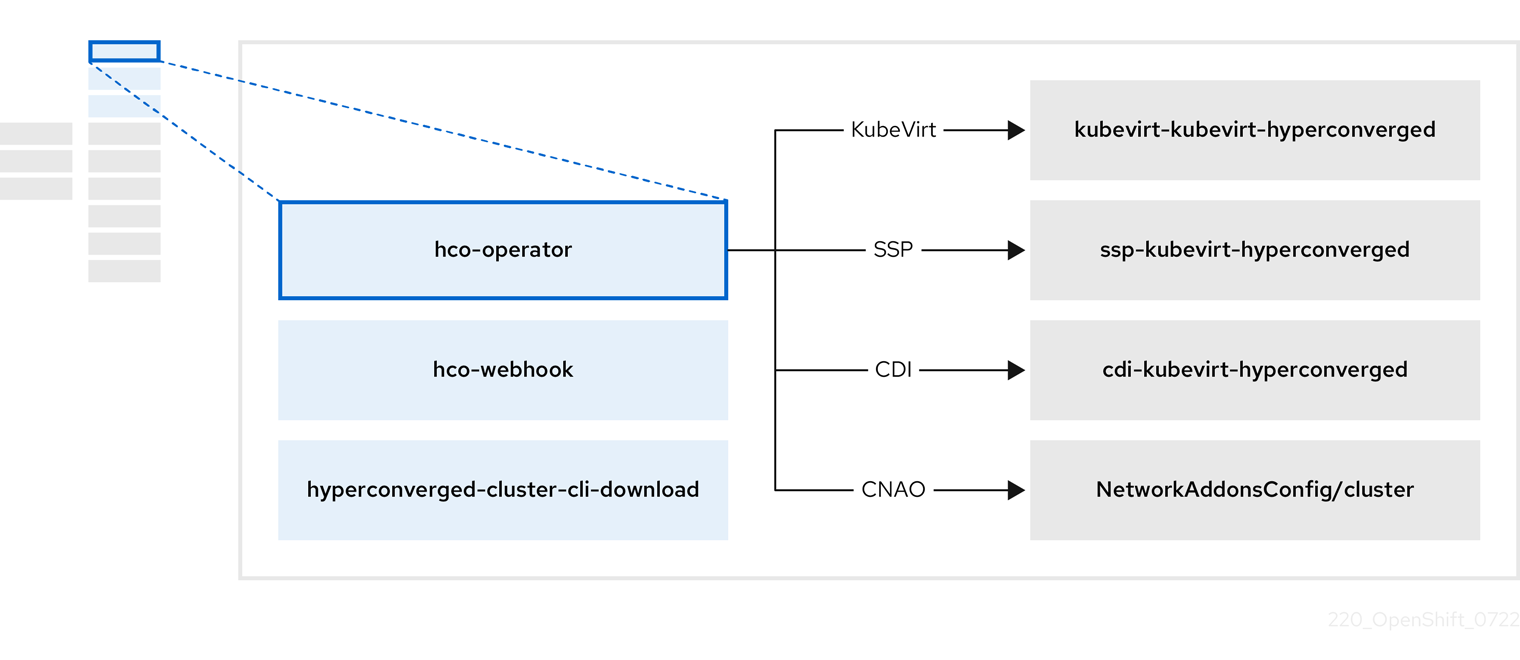

1.3.1. About the HyperConverged Operator (HCO)

The HCO, hco-operator, provides a single entry point for deploying and managing OpenShift Virtualization and several helper operators with opinionated defaults. It also creates custom resources (CRs) for those operators.

| Component | Description |

|---|---|

|

|

Validates the |

|

|

Provides the |

|

| Contains all operators, CRs, and objects needed by OpenShift Virtualization. |

|

| A Scheduling, Scale, and Performance (SSP) CR. This is automatically created by the HCO. |

|

| A Containerized Data Importer (CDI) CR. This is automatically created by the HCO. |

|

|

A CR that instructs and is managed by the |

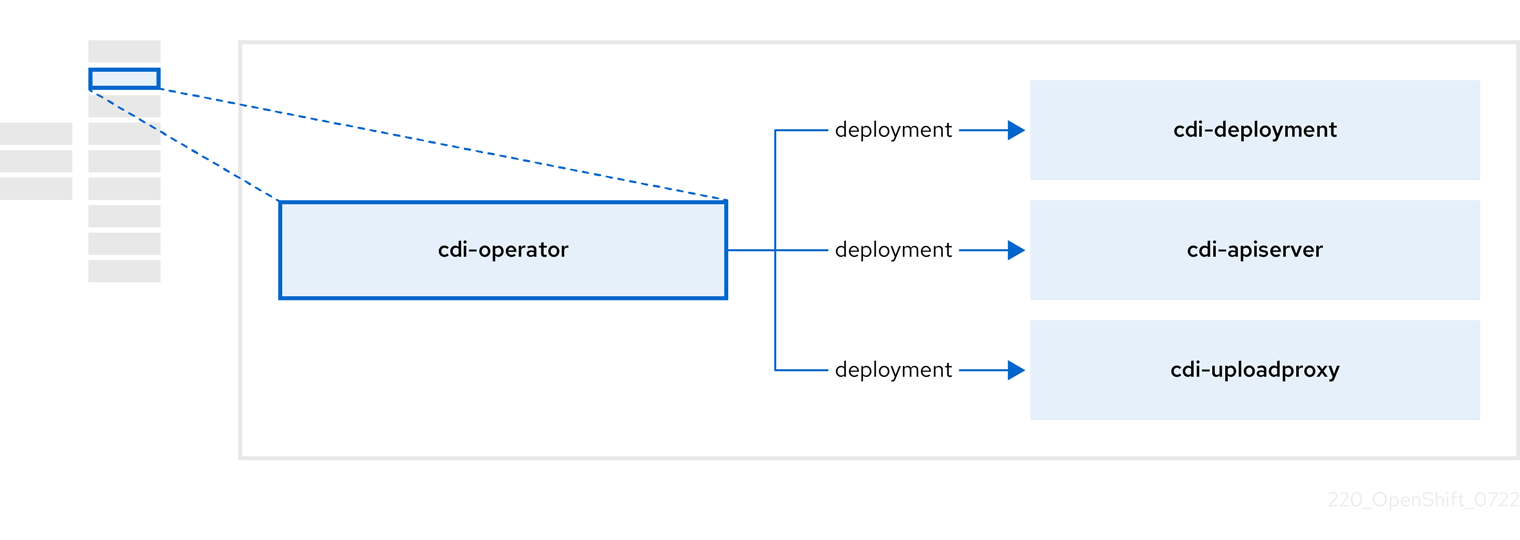

The CDI Operator, cdi-operator, manages CDI and its related resources, which imports a virtual machine (VM) image into a persistent volume claim (PVC) by using a data volume.

| Component | Description |

|---|---|

|

| Manages the authorization to upload VM disks into PVCs by issuing secure upload tokens. |

|

| Directs external disk upload traffic to the appropriate upload server pod so that it can be written to the correct PVC. Requires a valid upload token. |

|

| Helper pod that imports a virtual machine image into a PVC when creating a data volume. |

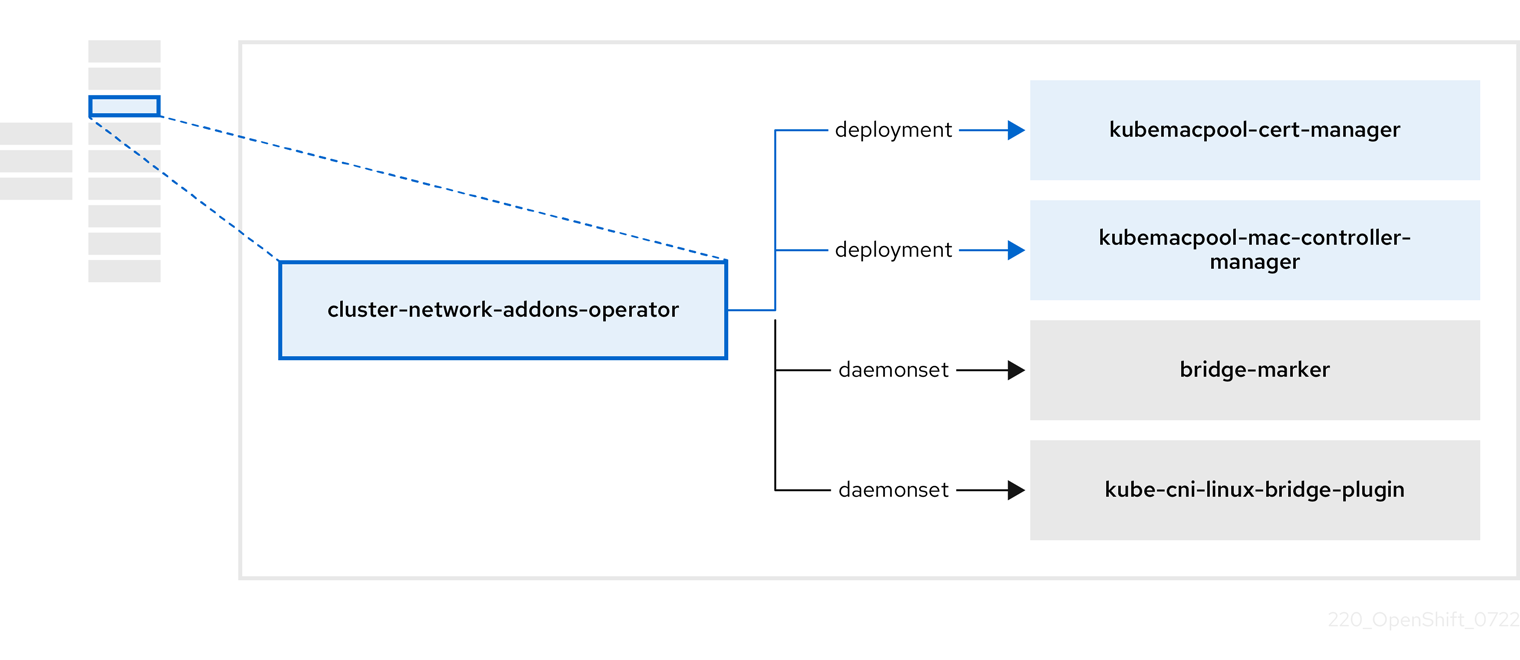

1.3.3. About the Cluster Network Addons Operator

The Cluster Network Addons Operator, cluster-network-addons-operator, deploys networking components on a cluster and manages the related resources for extended network functionality.

| Component | Description |

|---|---|

|

| Manages TLS certificates of Kubemacpool’s webhooks. |

|

| Provides a MAC address pooling service for virtual machine (VM) network interface cards (NICs). |

|

| Marks network bridges available on nodes as node resources. |

|

| Installs Container Network Interface (CNI) plugins on cluster nodes, enabling the attachment of VMs to Linux bridges through network attachment definitions. |

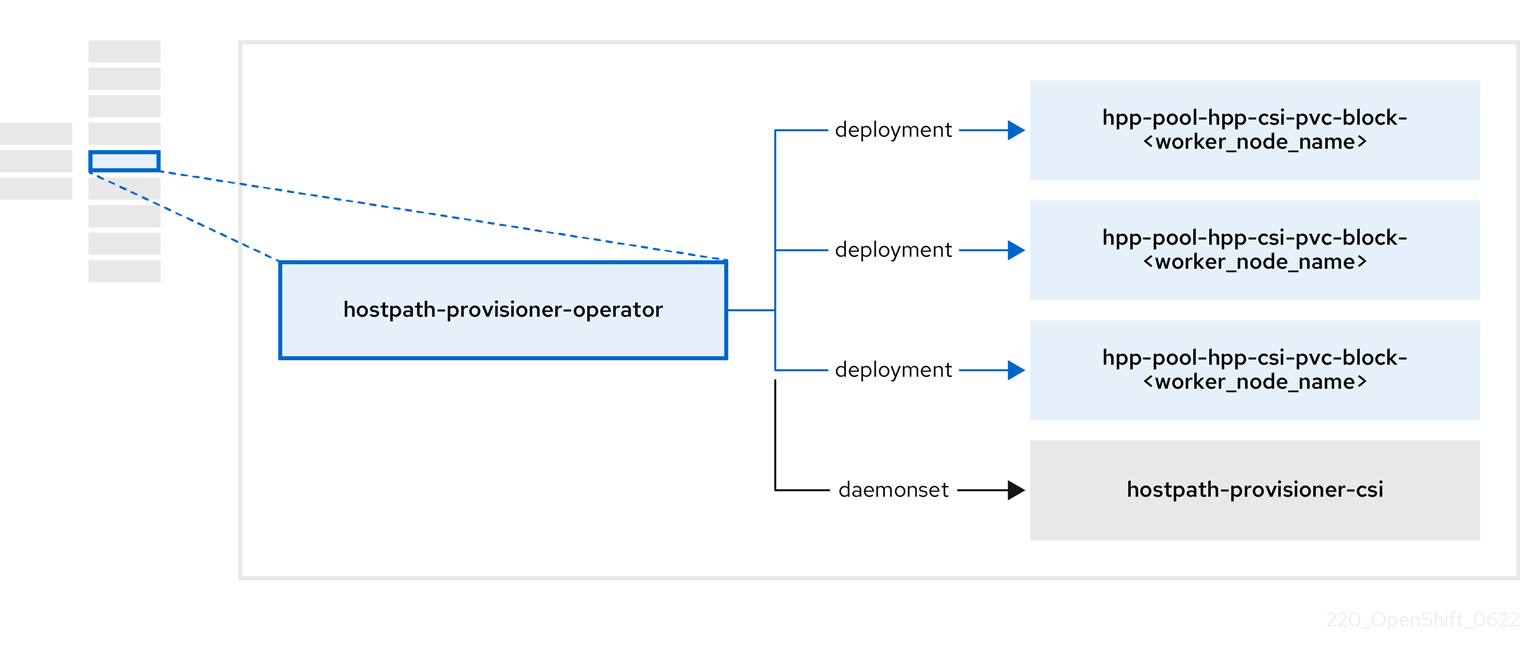

1.3.4. About the Hostpath Provisioner (HPP) Operator

The HPP Operator, hostpath-provisioner-operator, deploys and manages the multi-node HPP and related resources.

| Component | Description |

|---|---|

|

| Provides a worker for each node where the HPP is designated to run. The pods mount the specified backing storage on the node. |

|

| Implements the Container Storage Interface (CSI) driver interface of the HPP. |

|

| Implements the legacy driver interface of the HPP. |

The SSP Operator, ssp-operator, deploys the common templates, the related default boot sources, the pipeline tasks, and the template validator.

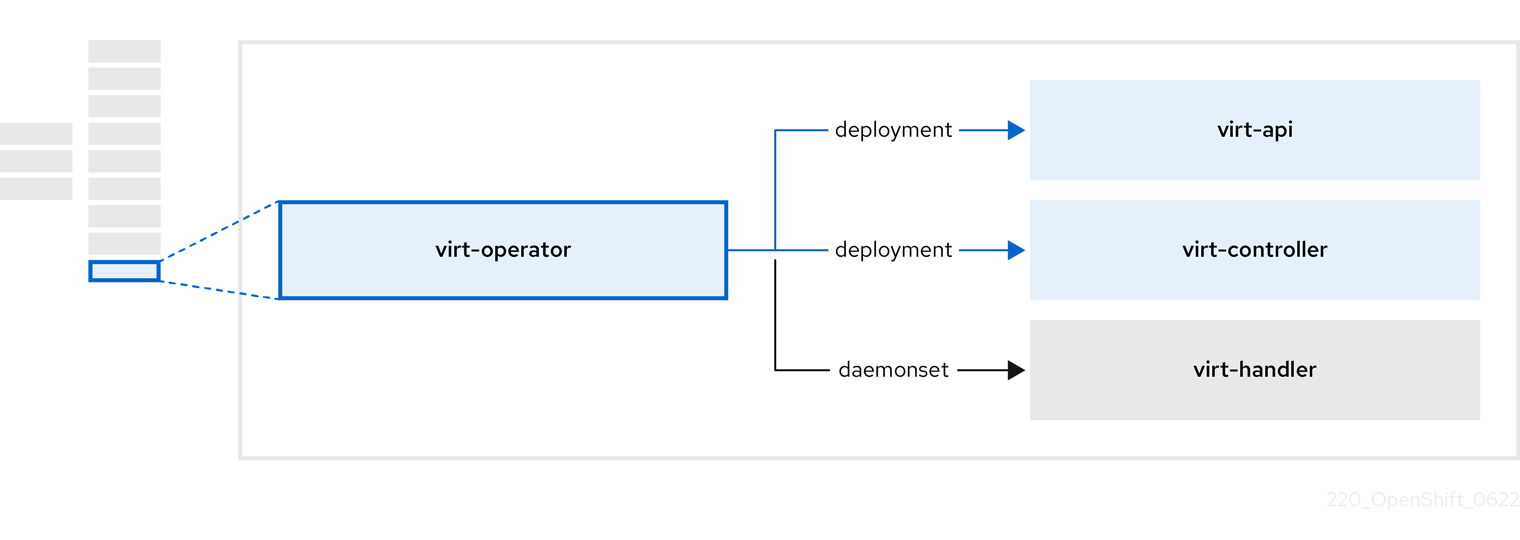

1.3.6. About the OpenShift Virtualization Operator

The OpenShift Virtualization Operator, virt-operator, deploys, upgrades, and manages OpenShift Virtualization without disrupting current virtual machine (VM) workloads. In addition, the OpenShift Virtualization Operator deploys the common instance types and common preferences.

| Component | Description |

|---|---|

|

| HTTP API server that serves as the entry point for all virtualization-related flows. |

|

|

Observes the creation of a new VM instance object and creates a corresponding pod. When the pod is scheduled on a node, |

|

|

Monitors any changes to a VM and instructs |

|

|

Contains the VM that was created by the user as implemented by |

Chapter 2. Getting started

2.1. Getting started with OpenShift Virtualization

Explore OpenShift Virtualization by taking guided tours, installing the Operator, and configuring a basic environment. Learn how to migrate from your current platform, then learn more about how to deploy and manage virtual machines (VMs) by following the additional resources links.

Cluster configuration procedures require cluster-admin privileges.

2.1.1. Migrating to OpenShift Virtualization

To migrate virtual machines from an external provider such as VMware vSphere, Red Hat OpenStack Platform (RHOSP), Red Hat Virtualization, or another Red Hat OpenShift Service on AWS cluster, use the Migration Toolkit for Virtualization (MTV). You can also migrate Open Virtual Appliance (OVA) files created by VMware vSphere.

Migration Toolkit for Virtualization is not part of OpenShift Virtualization and requires separate installation. For this reason, all links in this procedure lead outside of OpenShift Virtualization documentation.

Prerequisites

- The Migration Toolkit for Virtualization Operator is installed.

2.2. Using the CLI tools

You can manage OpenShift Virtualization resources by using the virtctl command-line tool. Virtual machine (VM) commands can also be used to manage virtual machine instances (VMIs) unless otherwise specified.

You can access and change VM disk images by using the libguestfs command-line tool. You deploy libguestfs by using the virtctl libguestfs command.

You can download the virtctl binary by using the Red Hat OpenShift Service on AWS web console and then install it on Red Hat Enterprise Linux (RHEL) 9 or later, Linux, Windows, or macOS.

Procedure

- Navigate to the Virtualization → Overview page in the web console.

-

Click the Download virtctl link to download the

virtctlbinary for your operating system. Install

virtctl:For RHEL and other Linux operating systems:

Decompress the archive file:

$ tar -xvf <virtctl-version-distribution.arch>.tar.gzRun the following command to make the

virtctlbinary executable:$ chmod +x <path/virtctl-file-name>Move the

virtctlbinary to a directory in yourPATHenvironment variable.You can check your path by running the following command:

$ echo $PATHSet the

KUBECONFIGenvironment variable:$ export KUBECONFIG=/home/<user>/clusters/current/auth/kubeconfig

For Windows:

- Decompress the archive file.

-

Navigate the extracted folder hierarchy and double-click the

virtctlexecutable file to install the client. Move the

virtctlbinary to a directory in yourPATHenvironment variable.You can check your path by running the following command:

C:\> path

For macOS:

- Decompress the archive file.

Move the

virtctlbinary to a directory in yourPATHenvironment variable.You can check your path by running the following command:

echo $PATH

2.2.2. virtctl information commands

You can use the following virtctl information commands to view information about the virtctl client.

| Command | Description |

|---|---|

|

|

View the |

|

|

View a list of |

|

| View a list of options for a specific command. |

|

|

View a list of global command options for any |

2.2.3. VM information commands

You can use virtctl to view information about virtual machines (VMs) and virtual machine instances (VMIs).

| Command | Description |

|---|---|

|

| View the file systems available on a guest machine. |

|

| View information about the operating systems on a guest machine. |

|

| View the logged-in users on a guest machine. |

2.2.4. VM manifest creation commands

You can use the following virtctl create commands to create manifests for virtual machines, instance types, and preferences.

| Command | Description |

|---|---|

|

Create a |

|

| Create a VM manifest, specifying a name for the VM. |

|

| Create a VM manifest with a cloud-init configuration to create the selected user and either add an SSH public key from the supplied string, or a password from a file. |

|

| Create a VM manifest with a user and password combination injected from the selected secret. |

|

| Create a VM manifest with an SSH public key injected from the selected secret. |

|

|

Create a VM manifest, specifying a config map to use as the sysprep volume. The config map must contain a valid answer file named |

|

| Create a VM manifest that uses an existing cluster-wide instance type. |

|

| Create a VM manifest that uses an existing namespaced instance type. |

|

| Create a manifest for a cluster-wide instance type. |

|

| Create a manifest for a namespaced instance type. |

|

| Create a manifest for a cluster-wide VM preference, specifying a name for the preference. |

|

| Create a manifest for a namespaced VM preference. |

2.2.5. VM management commands

You can use the following virtctl commands to manage and migrate virtual machines (VMs) and VM instances (VMIs).

| Command | Description |

|---|---|

|

| Start a VM. |

|

| Start a VM in a paused state. This option enables you to interrupt the boot process from the VNC console. |

|

| Stop a VM. |

|

| Force stop a VM. This option might cause data inconsistency or data loss. |

|

| Pause a VM. The machine state is kept in memory. |

|

| Unpause a VM. |

|

| Migrate a VM. |

|

| Cancel a VM migration. |

|

| Restart a VM. |

2.2.6. VM connection commands

You use can use the following virtctl commands to expose ports and connect to virtual machines (VMs) and VM instances (VMIs).

| Command | Description |

|---|---|

|

| Connect to the serial console of a VM. |

|

| Create a service that forwards a designated port of a VM and expose the service on the specified port of the node.

Example: |

|

| Copy a file from your machine to a VM. This command uses the private key of an SSH key pair. The VM must be configured with the public key. |

|

| Copy a file from a VM to your machine. This command uses the private key of an SSH key pair. The VM must be configured with the public key. |

|

| Open an SSH connection with a VM. This command uses the private key of an SSH key pair. The VM must be configured with the public key. |

|

| Connect to the VNC console of a VM.

You must have |

|

| Display the port number and connect manually to a VM by using any viewer through the VNC connection. |

|

| Specify a port number to run the proxy on the specified port, if that port is available. If a port number is not specified, the proxy runs on a random port. |

2.2.7. VM export commands

Use virtctl vmexport commands to create, download, or delete a volume exported from a VM, VM snapshot, or persistent volume claim (PVC). Certain manifests also contain a header secret, which grants access to the endpoint to import a disk image in a format that OpenShift Virtualization can use.

| Command | Description |

|---|---|

|

|

Create a

|

|

|

Delete a |

|

|

Download the volume defined in a

Optional:

|

|

|

Create a |

|

| Retrieve the manifest for an existing export. The manifest does not include the header secret. |

|

| Create a VM export for a VM example, and retrieve the manifest. The manifest does not include the header secret. |

|

| Create a VM export for a VM snapshot example, and retrieve the manifest. The manifest does not include the header secret. |

|

| Retrieve the manifest for an existing export. The manifest includes the header secret. |

|

| Retrieve the manifest for an existing export in json format. The manifest does not include the header secret. |

|

| Retrieve the manifest for an existing export. The manifest includes the header secret and writes it to the file specified. |

2.2.8. Hot plug and hot unplug commands

You can use the following virtctl commands to add or remove resources from running virtual machines (VMs) and VM instances (VMIs).

| Command | Description |

|---|---|

|

| Hot plug a data volume or persistent volume claim (PVC). Optional:

|

|

| Hot unplug a virtual disk. |

2.2.9. Image upload commands

You can use the following virtctl image-upload commands to upload a VM image to a data volume.

| Command | Description |

|---|---|

|

| Upload a VM image to a data volume that already exists. |

|

| Upload a VM image to a new data volume of a specified requested size. |

|

|

Upload a VM image to a new data volume and create an associated |

2.2.10. Deploying libguestfs by using virtctl

You can use the virtctl guestfs command to deploy an interactive container with libguestfs-tools and a persistent volume claim (PVC) attached to it.

Procedure

To deploy a container with

libguestfs-tools, mount the PVC, and attach a shell to it, run the following command:$ virtctl guestfs -n <namespace> <pvc_name>ImportantThe

<pvc_name>argument is required. If you do not include it, an error message appears.

2.2.11. Libguestfs and virtctl guestfs commands

Libguestfs tools help you access and modify virtual machine (VM) disk images. You can use libguestfs tools to view and edit files in a guest, clone and build virtual machines, and format and resize disks.

You can also use the virtctl guestfs command and its sub-commands to modify, inspect, and debug VM disks on a PVC. To see a complete list of possible sub-commands, enter virt- on the command line and press the Tab key. For example:

| Command | Description |

|---|---|

|

| Edit a file interactively in your terminal. |

|

| Inject an ssh key into the guest and create a login. |

|

| See how much disk space is used by a VM. |

|

| See the full list of all RPMs installed on a guest by creating an output file containing the full list. |

|

|

Display the output file list of all RPMs created using the |

|

| Seal a virtual machine disk image to be used as a template. |

By default, virtctl guestfs creates a session with everything needed to manage a VM disk. However, the command also supports several flag options if you want to customize the behavior:

| Flag Option | Description |

|---|---|

|

|

Provides help for |

|

| To use a PVC from a specific namespace.

If you do not use the

If you do not include a |

|

|

Lists the

You can configure the container to use a custom image by using the |

|

|

Indicates that

By default,

If a cluster does not have any

If not set, the |

|

|

Shows the pull policy for the

You can also overwrite the image’s pull policy by setting the |

The command also checks if a PVC is in use by another pod, in which case an error message appears. However, once the libguestfs-tools process starts, the setup cannot avoid a new pod using the same PVC. You must verify that there are no active virtctl guestfs pods before starting the VM that accesses the same PVC.

The virtctl guestfs command accepts only a single PVC attached to the interactive pod.

Chapter 3. Installing

3.1. Preparing your cluster for OpenShift Virtualization

Review platform compatibility information before you install OpenShift Virtualization. For detailed system requirements, see "Hardware, software, and operational requirements" in the Additional resources section.

You can run OpenShift Virtualization on a Red Hat OpenShift Service on AWS cluster.

- Installing

-

You can install the cluster by using installer-provisioned infrastructure, ensuring that you specify bare-metal instance types for the worker nodes. For example, you can use the

c5n.metaltype value for a machine based on x86_64 architecture.

-

You can install the cluster by using installer-provisioned infrastructure, ensuring that you specify bare-metal instance types for the worker nodes. For example, you can use the

- Accessing virtual machines (VMs)

-

There is no change to how you access VMs by using the

virtctlCLI tool or the Red Hat OpenShift Service on AWS web console. You can expose VMs by using a

NodePortorLoadBalancerservice.NoteThe load balancer approach is preferable because Red Hat OpenShift Service on AWS automatically creates the load balancer in AWS and manages its lifecycle. A security group is also created for the load balancer, and you can use annotations to attach existing security groups. When you remove the service, Red Hat OpenShift Service on AWS removes the load balancer and its associated resources.

-

There is no change to how you access VMs by using the

- Storage

You can use any storage solution that is certified by the storage vendor to work with the underlying platform.

ImportantAWS bare metal, Red Hat OpenShift Service on AWS, and Red Hat OpenShift Service on AWS classic architecture clusters might have different supported storage solutions. Ensure that you confirm support with your storage vendor.

Using Amazon Elastic File System (EFS) or Amazon Elastic Block Store (EBS) with OpenShift Virtualization might cause performance and functionality limitations as shown in the following table:

Expand Table 3.1. EFS and EBS performance and functionality limitations Feature EBS volume EFS volume Shared storage solutions gp2

gp3

io2

VM live migration

Not available

Not available

Available

Available

Available

Fast VM creation by using cloning

Available

Not available

Available

VM backup and restore by using snapshots

Available

Not available

Available

Consider using CSI storage, which supports ReadWriteMany (RWX), cloning, and snapshots to enable live migration, fast VM creation, and VM snapshots capabilities.

3.1.2. ARM64 compatibility

OpenShift Virtualization on ARM64 systems is generally available (GA) with specific limitations for operating systems and live migration.

Before using OpenShift Virtualization on an ARM64-based system, consider the following limitations:

- Operating system

- Only Linux-based guest operating systems are supported.

- All virtualization limitations for RHEL also apply to OpenShift Virtualization. For more information, see How virtualization on ARM64 differs from AMD64 and Intel 64 in the RHEL documentation.

- Live migration

- Live migration is not supported on ARM64-based Red Hat OpenShift Service on AWS clusters.

- Hotplug is not supported on ARM64-based clusters because it depends on live migration.

- VM creation

- RHEL 10 supports instance types and preferences, but not templates.

- RHEL 9 supports templates, instance types, and preferences.

3.2. Installing OpenShift Virtualization

Install OpenShift Virtualization to add virtualization functionality to your Red Hat OpenShift Service on AWS cluster.

You can deploy the OpenShift Virtualization Operator by using the Red Hat OpenShift Service on AWS web console.

Prerequisites

- Install Red Hat OpenShift Service on AWS 4 on your cluster.

-

Log in to the Red Hat OpenShift Service on AWS web console as a user with

cluster-adminpermissions. - Create a machine pool based on a bare metal compute node instance type. For more information, see "Creating a machine pool" in the Additional resources of this section.

Procedure

- From the Administrator perspective, click Ecosystem → Software Catalog.

- In the Filter by keyword field, type Virtualization.

- Select the OpenShift Virtualization Operator tile with the Red Hat source label.

- Read the information about the Operator and click Install.

On the Install Operator page:

- Select stable from the list of available Update Channel options. This ensures that you install the version of OpenShift Virtualization that is compatible with your Red Hat OpenShift Service on AWS version.

For Installed Namespace, ensure that the Operator recommended namespace option is selected. This installs the Operator in the mandatory

openshift-cnvnamespace, which is automatically created if it does not exist.WarningAttempting to install the OpenShift Virtualization Operator in a namespace other than

openshift-cnvcauses the installation to fail.For Approval Strategy, it is highly recommended that you select Automatic, which is the default value, so that OpenShift Virtualization automatically updates when a new version is available in the stable update channel.

Selecting the Manual approval strategy is not recommended, as it poses a high risk to cluster support and functionality. Only select Manual if you fully understand these risks and cannot use Automatic.

WarningBecause OpenShift Virtualization is only supported when used with the corresponding Red Hat OpenShift Service on AWS version, missing OpenShift Virtualization updates can cause your cluster to become unsupported.

-

Click Install to make the Operator available to the

openshift-cnvnamespace. - When the Operator installs successfully, click Create HyperConverged.

- Optional: Configure Infra and Workloads node placement options for OpenShift Virtualization components.

- Click Create to launch OpenShift Virtualization.

Verification

- Navigate to the Workloads → Pods page and monitor the OpenShift Virtualization pods until they are all Running. After all the pods display the Running state, you can use OpenShift Virtualization.

Before you install OpenShift Virtualization, you must subscribe to the OpenShift Virtualization catalog. Subscribing gives the openshift-cnv namespace access to the OpenShift Virtualization Operators.

To subscribe, configure Namespace, OperatorGroup, and Subscription objects by applying a single manifest to your cluster.

Prerequisites

- Install Red Hat OpenShift Service on AWS 4 on your cluster.

-

Install the OpenShift CLI (

oc). -

Log in as a user with

cluster-adminprivileges.

Procedure

Create a YAML file that contains the following manifest:

apiVersion: v1 kind: Namespace metadata: name: openshift-cnv labels: openshift.io/cluster-monitoring: "true" --- apiVersion: operators.coreos.com/v1 kind: OperatorGroup metadata: name: kubevirt-hyperconverged-group namespace: openshift-cnv spec: targetNamespaces: - openshift-cnv --- apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: hco-operatorhub namespace: openshift-cnv spec: source: redhat-operators sourceNamespace: openshift-marketplace name: kubevirt-hyperconverged startingCSV: kubevirt-hyperconverged-operator.v4.21.8 channel: "stable"Using the

stablechannel ensures that you install the version of OpenShift Virtualization that is compatible with your Red Hat OpenShift Service on AWS version.Create the required

Namespace,OperatorGroup, andSubscriptionobjects for OpenShift Virtualization by running the following command:$ oc apply -f <filename>.yaml

Verification

You must verify that the subscription creation was successful before you can proceed with installing OpenShift Virtualization.

Check that the

ClusterServiceVersion(CSV) object was created successfully. Run the following command and verify the output:$ oc get csv -n openshift-cnvIf the CSV was created successfully, the output shows an entry that contains a

NAMEvalue ofkubevirt-hyperconverged-operator-*, aDISPLAYvalue ofOpenShift Virtualization, and aPHASEvalue ofSucceeded, as shown in the following example output:Example output:

NAME DISPLAY VERSION REPLACES PHASE kubevirt-hyperconverged-operator.v4.21.8 OpenShift Virtualization 4.21.8 kubevirt-hyperconverged-operator.v4.20.0 SucceededCheck that the

HyperConvergedcustom resource (CR) has the correct version. Run the following command and verify the output:$ oc get hco -n openshift-cnv kubevirt-hyperconverged -o json | jq .status.versionsExample output:

{ "name": "operator", "version": "4.21.8" }Verify the

HyperConvergedCR conditions. Run the following command and check the output:$ oc get hco kubevirt-hyperconverged -n openshift-cnv -o json | jq -r '.status.conditions[] | {type,status}'Example output:

{ "type": "ReconcileComplete", "status": "True" } { "type": "Available", "status": "True" } { "type": "Progressing", "status": "False" } { "type": "Degraded", "status": "False" } { "type": "Upgradeable", "status": "True" }

You can deploy the OpenShift Virtualization Operator by using the oc CLI.

Prerequisites

-

Install the OpenShift CLI (

oc). -

Subscribe to the OpenShift Virtualization catalog in the

openshift-cnvnamespace. -

Log in as a user with

cluster-adminprivileges. - Create a machine pool based on a bare metal compute node instance type.

Procedure

Create a YAML file that contains the following manifest:

apiVersion: hco.kubevirt.io/v1beta1 kind: HyperConverged metadata: name: kubevirt-hyperconverged namespace: openshift-cnv spec:Deploy the OpenShift Virtualization Operator by running the following command:

$ oc apply -f <file_name>.yaml

Verification

Ensure that OpenShift Virtualization deployed successfully by watching the

PHASEof the cluster service version (CSV) in theopenshift-cnvnamespace. Run the following command:$ watch oc get csv -n openshift-cnvThe following output displays if deployment was successful:

NAME DISPLAY VERSION REPLACES PHASE kubevirt-hyperconverged-operator.v4.21.8 OpenShift Virtualization 4.21.8 Succeeded

3.3. Uninstalling OpenShift Virtualization

You can uninstall OpenShift Virtualization by using the web console or the command-line interface (CLI) to delete OpenShift Virtualization workloads, the Operator, and its resources.

To uninstall OpenShift Virtualization, perform the following tasks:

-

Delete the

HyperConvergedCR. - Delete the OpenShift Virtualization Operator.

-

Delete the

openshift-cnvnamespace. - Delete the OpenShift Virtualization custom resource definitions (CRDs).

3.3.1. Prerequisites

- Delete all virtual machine instances. You cannot uninstall OpenShift Virtualization while its workloads remain on the cluster.

3.3.2. Deleting the HyperConverged custom resource

To uninstall OpenShift Virtualization, you first delete the HyperConverged custom resource (CR).

Prerequisites

-

You have access to an Red Hat OpenShift Service on AWS cluster using an account with

cluster-adminpermissions.

Procedure

- Navigate to the Ecosystem → Installed Operators page.

- Select the OpenShift Virtualization Operator.

- Click the OpenShift Virtualization Deployment tab.

-

Click the Options menu

beside

beside kubevirt-hyperconvergedand select Delete HyperConverged. - Click Delete in the confirmation window.

Cluster administrators can delete installed Operators from a selected namespace by using the web console.

Prerequisites

-

You have access to the Red Hat OpenShift Service on AWS cluster web console using an account with

dedicated-adminpermissions.

Procedure

- Navigate to the Ecosystem → Installed Operators page.

- Scroll or enter a keyword into the Filter by name field to find the Operator that you want to remove. Then, click on it.

On the right side of the Operator Details page, select Uninstall Operator from the Actions list.

An Uninstall Operator? dialog box is displayed.

Select Uninstall to remove the Operator, Operator deployments, and pods. Following this action, the Operator stops running and no longer receives updates.

NoteThis action does not remove resources managed by the Operator, including custom resource definitions (CRDs) and custom resources (CRs). Dashboards and navigation items enabled by the web console and off-cluster resources that continue to run might need manual clean up. To remove these after uninstalling the Operator, you might need to manually delete the Operator CRDs.

3.3.4. Deleting a namespace using the web console

You can delete a namespace by using the Red Hat OpenShift Service on AWS web console.

Prerequisites

-

You have access to the Red Hat OpenShift Service on AWS cluster using an account with

cluster-adminpermissions.

Procedure

- Navigate to Administration → Namespaces.

- Locate the namespace that you want to delete in the list of namespaces.

-

On the far right side of the namespace listing, select Delete Namespace from the Options menu

.

.

- When the Delete Namespace pane opens, enter the name of the namespace that you want to delete in the field.

- Click Delete.

You can delete the OpenShift Virtualization custom resource definitions (CRDs) by using the web console.

Prerequisites

-

You have access to the Red Hat OpenShift Service on AWS cluster using an account with

cluster-adminpermissions.

Procedure

- Navigate to Administration → CustomResourceDefinitions.

-

Select the Label filter and enter

operators.coreos.com/kubevirt-hyperconverged.openshift-cnvin the Search field to display the OpenShift Virtualization CRDs. -

Click the Options menu

beside each CRD and select Delete CustomResourceDefinition.

beside each CRD and select Delete CustomResourceDefinition.

You can uninstall OpenShift Virtualization by using the OpenShift CLI (oc).

Prerequisites

-

You have access to the Red Hat OpenShift Service on AWS cluster using an account with

cluster-adminpermissions. -

You have installed the OpenShift CLI (

oc). - You have deleted all virtual machines and virtual machine instances. You cannot uninstall OpenShift Virtualization while its workloads remain on the cluster.

Procedure

Delete the

HyperConvergedcustom resource:$ oc delete HyperConverged kubevirt-hyperconverged -n openshift-cnvDelete the OpenShift Virtualization Operator subscription:

$ oc delete subscription hco-operatorhub -n openshift-cnvDelete the OpenShift Virtualization

ClusterServiceVersionresource:$ oc delete csv -n openshift-cnv -l operators.coreos.com/kubevirt-hyperconverged.openshift-cnvDelete the OpenShift Virtualization namespace:

$ oc delete namespace openshift-cnvList the OpenShift Virtualization custom resource definitions (CRDs) by running the

oc delete crdcommand with thedry-runoption:$ oc delete crd --dry-run=client -l operators.coreos.com/kubevirt-hyperconverged.openshift-cnvExample output:

customresourcedefinition.apiextensions.k8s.io "cdis.cdi.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "hostpathprovisioners.hostpathprovisioner.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "hyperconvergeds.hco.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "kubevirts.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "networkaddonsconfigs.networkaddonsoperator.network.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "ssps.ssp.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "tektontasks.tektontasks.kubevirt.io" deleted (dry run)Delete the CRDs by running the

oc delete crdcommand without thedry-runoption:$ oc delete crd -l operators.coreos.com/kubevirt-hyperconverged.openshift-cnv

Chapter 4. Post-installation configuration

4.1. Postinstallation configuration

The following procedures are typically performed after you install OpenShift Virtualization. You can configure the components that are relevant for your environment:

- The hostpath provisioner is a local storage provisioner designed for OpenShift Virtualization. If you want to configure local storage for virtual machines, you must enable the hostpath provisioner first.

- Node placement rules for OpenShift Virtualization Operators, workloads, and controllers.

Network configuration:

- Enabling the creation of load balancer services by using the Red Hat OpenShift Service on AWS web console

Storage configuration:

- Defining a default storage class for the Container Storage Interface (CSI)

- Configuring local storage by using the Hostpath Provisioner (HPP)

You can configure node placement rules to specify where OpenShift Virtualization Operators, workloads, and controllers are deployed. While default scheduling is sufficient for standard environments, custom placement rules allow you to isolate virtual machine (VM) traffic or dedicate specialized compute resources to critical workloads.

You can configure node placement rules for some components after installing OpenShift Virtualization, but virtual machines cannot be present if you want to configure node placement rules for workloads.

You can use node placement rules to deploy virtual machines only on nodes intended for virtualization workloads, to deploy Operators only on infrastructure nodes, or to maintain separation between workloads.

Depending on the object, you can use one or more of the following rule types:

nodeSelector- Allows pods to be scheduled on nodes that are labeled with the key-value pair or pairs that you specify in this field. The node must have labels that exactly match all listed pairs.

affinity- Enables you to use more expressive syntax to set rules that match nodes with pods. Affinity also allows for more nuance in how the rules are applied. For example, you can specify that a rule is a preference, not a requirement. If a rule is a preference, pods are still scheduled when the rule is not satisfied.

tolerations- Allows pods to be scheduled on nodes that have matching taints. If a taint is applied to a node, that node only accepts pods that tolerate the taint.

4.2.2. Applying node placement rules

To ensure that virtualization components run on the most suitable nodes for your workload requirements, you can apply node placement rules by editing the Subscription, HyperConverged, or HostPathProvisioner objects.

Prerequisites

-

You have installed the OpenShift CLI (

oc). - You are logged in with cluster administrator permissions.

Procedure

Edit the object in your default editor by running the following command:

$ oc edit <resource_type> <resource_name> -n openshift-cnv- Save the file to apply the changes.

4.2.3. Node placement rule examples

You can specify node placement rules for a OpenShift Virtualization component by editing a Subscription, HyperConverged, or HostPathProvisioner object.

To specify the nodes where OLM deploys the OpenShift Virtualization Operators, edit the Subscription object during OpenShift Virtualization installation.

Currently, you cannot configure node placement rules for the Subscription object by using the web console.

The Subscription object does not support the affinity node placement rule.

Example Subscription object with nodeSelector rule:

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: hco-operatorhub

namespace: openshift-cnv

spec:

source: redhat-operators

sourceNamespace: openshift-marketplace

name: kubevirt-hyperconverged

startingCSV: kubevirt-hyperconverged-operator.v4.21.8

channel: "stable"

config:

nodeSelector:

example.io/example-infra-key: example-infra-value

OLM deploys the OpenShift Virtualization Operators on nodes labeled example.io/example-infra-key = example-infra-value.

Example Subscription object with tolerations rule:

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: hco-operatorhub

namespace: openshift-cnv

spec:

source: redhat-operators

sourceNamespace: openshift-marketplace

name: kubevirt-hyperconverged

startingCSV: kubevirt-hyperconverged-operator.v4.21.8

channel: "stable"

config:

tolerations:

- key: "key"

operator: "Equal"

value: "virtualization"

effect: "NoSchedule"

OLM deploys OpenShift Virtualization Operators on nodes labeled key = virtualization:NoSchedule taint. Only pods with the matching tolerations are scheduled on these nodes.

To specify the nodes where OpenShift Virtualization deploys its components, you can edit the nodePlacement object in the HyperConverged custom resource (CR) file that you create during OpenShift Virtualization installation.

Example HyperConverged object with nodeSelector rule:

apiVersion: hco.kubevirt.io/v1beta1

kind: HyperConverged

metadata:

name: kubevirt-hyperconverged

namespace: openshift-cnv

spec:

infra:

nodePlacement:

nodeSelector:

example.io/example-infra-key: example-infra-value

workloads:

nodePlacement:

nodeSelector:

example.io/example-workloads-key: example-workloads-value-

Infrastructure resources are placed on nodes labeled

example.io/example-infra-key = example-infra-value. -

Workloads are placed on nodes labeled

example.io/example-workloads-key = example-workloads-value.

Example HyperConverged object with affinity rule:

apiVersion: hco.kubevirt.io/v1beta1

kind: HyperConverged

metadata:

name: kubevirt-hyperconverged

namespace: openshift-cnv

spec:

infra:

nodePlacement:

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

nodeSelectorTerms:

- matchExpressions:

- key: example.io/example-infra-key

operator: In

values:

- example-infra-value

workloads:

nodePlacement:

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

nodeSelectorTerms:

- matchExpressions:

- key: example.io/example-workloads-key

operator: In

values:

- example-workloads-value

preferredDuringSchedulingIgnoredDuringExecution:

- weight: 1

preference:

matchExpressions:

- key: example.io/num-cpus

operator: Gt

values:

- 8-

Infrastructure resources are placed on nodes labeled

example.io/example-infra-key = example-value. -

Workloads are placed on nodes labeled

example.io/example-workloads-key = example-workloads-value. - Nodes that have more than eight CPUs are preferred for workloads, but if they are not available, pods are still scheduled.

Example HyperConverged object with tolerations rule:

apiVersion: hco.kubevirt.io/v1beta1

kind: HyperConverged

metadata:

name: kubevirt-hyperconverged

namespace: openshift-cnv

spec:

workloads:

nodePlacement:

tolerations:

- key: "key"

operator: "Equal"

value: "virtualization"

effect: "NoSchedule"

Nodes reserved for OpenShift Virtualization components are labeled with the key = virtualization:NoSchedule taint. Only pods with matching tolerations are scheduled on reserved nodes.

You can edit the HostPathProvisioner object directly or by using the web console.

You must schedule the hostpath provisioner (HPP) and the OpenShift Virtualization components on the same nodes. Otherwise, virtualization pods that use the hostpath provisioner cannot run. You cannot run virtual machines.

After you deploy a virtual machine (VM) with the HPP storage class, you can remove the hostpath provisioner pod from the same node by using the node selector. However, you must first revert that change, at least for that specific node, and wait for the pod to run before trying to delete the VM.

You can configure node placement rules by specifying nodeSelector, affinity, or tolerations for the spec.workload field of the HostPathProvisioner object that you create when you install the hostpath provisioner.

Example HostPathProvisioner object with nodeSelector rule:

apiVersion: hostpathprovisioner.kubevirt.io/v1beta1

kind: HostPathProvisioner

metadata:

name: hostpath-provisioner

spec:

imagePullPolicy: IfNotPresent

pathConfig:

path: "</path/to/backing/directory>"

useNamingPrefix: false

workload:

nodeSelector:

example.io/example-workloads-key: example-workloads-value

Workloads are placed on nodes labeled example.io/example-workloads-key = example-workloads-value.

4.3. Postinstallation network configuration

By default, OpenShift Virtualization uses a single internal pod network after installation.

4.3.1. Creating a Linux bridge NNCP

After you install the Kubernetes NMState Operator, you can configure a Linux bridge network for live migration or external access to virtual machines (VMs).

You can create a NodeNetworkConfigurationPolicy (NNCP) manifest for a Linux bridge network.

Prerequisites

- You have installed the Kubernetes NMState Operator.

Procedure

Create the

NodeNetworkConfigurationPolicymanifest. This example includes sample values that you must replace with your own information.apiVersion: nmstate.io/v1 kind: NodeNetworkConfigurationPolicy metadata: name: br1-eth1-policy spec: desiredState: interfaces: - name: br1 description: Linux bridge with eth1 as a port type: linux-bridge state: up ipv4: enabled: false bridge: options: stp: enabled: false port: - name: eth1-

metadata.namedefines the name of the node network configuration policy. -

spec.desiredState.interfaces.namedefines the name of the new Linux bridge. -

spec.desiredState.interfaces.descriptionis an optional field that can be used to define a human-readable description for the bridge. -

spec.desiredState.interfaces.typedefines the interface type. In this example, the type is a Linux bridge. -

spec.desiredState.interfaces.statedefines the requested state for the interface after creation. -

spec.desiredState.interfaces.ipv4.enableddefines whether the ipv4 protocol is active. Setting this tofalsedisables IPv4 addressing on this bridge. -

spec.desiredState.interfaces.bridge.options.stp.enableddefines whether Spanning Tree Protocol (STP) is active. Setting this tofalsedisables STP on this bridge. spec.desiredState.interfaces.bridge.port.namedefines the node NIC that the bridge is attached to.NoteTo create the NNCP manifest for a Linux bridge using Open Systems Adapter (OSA) with IBM Z®, you must disable VLAN filtering by the setting the

rx-vlan-filtertofalsein theNodeNetworkConfigurationPolicymanifest.Alternatively, if you have SSH access to the node, you can disable VLAN filtering by running the following command:

$ sudo ethtool -K <osa-interface-name> rx-vlan-filter off

-

Use the Red Hat OpenShift Service on AWS web console to create a network attachment definition (NAD) that connects pods and virtual machines to a layer-2 network.

Configuring IP address management (IPAM) in a network attachment definition for virtual machines is not supported.

Procedure

- In the web console, click Networking → NetworkAttachmentDefinitions.

Click Create Network Attachment Definition.

NoteThe network attachment definition must be in the same namespace as the pod or virtual machine.

- Enter a unique Name and optional Description.

- Select CNV Linux bridge from the Network Type list.

- Enter the name of the bridge in the Bridge Name field.

Optional: If the resource has VLAN IDs configured, enter the ID numbers in the VLAN Tag Number field.

NoteOpen Systems Adapter (OSA) interfaces on IBM Z® do not support VLAN filtering and drop VLAN-tagged traffic. Avoid using VLAN-tagged NADs with OSA interfaces.

- Optional: Select MAC Spoof Check to enable MAC spoof filtering. This feature provides security against a MAC spoofing attack by allowing only a single MAC address to exit the pod.

- Click Create.

After you have configured a Linux bridge network, you can configure a dedicated network for live migration. A dedicated network minimizes the effects of network saturation on tenant workloads during live migration.

To configure a dedicated secondary network for live migration, you must first create a bridge network attachment definition (NAD) by using the CLI. You can then add the name of the NetworkAttachmentDefinition object to the HyperConverged custom resource (CR).

Prerequisites

-

You installed the OpenShift CLI (

oc). -

You logged in to the cluster as a user with the

cluster-adminrole. - Each node has at least two Network Interface Cards (NICs).

- The NICs for live migration are connected to the same VLAN.

Procedure

Create a

NetworkAttachmentDefinitionmanifest according to the following example:apiVersion: "k8s.cni.cncf.io/v1" kind: NetworkAttachmentDefinition metadata: name: my-secondary-network namespace: openshift-cnv spec: config: '{ "cniVersion": "0.3.1", "name": "migration-bridge", "type": "macvlan", "master": "eth1", "mode": "bridge", "ipam": { "type": "whereabouts", "range": "10.200.5.0/24" } }'-

metadata.namedefines the name of theNetworkAttachmentDefinitionobject. -

config.masterdefines the name of the NIC to be used for live migration. -

config.typedefines the name of the CNI plugin that provides the network for the NAD. -

config.rangedefines an IP address range for the secondary network. This range must not overlap the IP addresses of the main network.

-

Open the

HyperConvergedCR in your default editor by running the following command:$ oc edit hyperconverged kubevirt-hyperconverged -n openshift-cnvAdd the name of the

NetworkAttachmentDefinitionobject to thespec.liveMigrationConfigstanza of theHyperConvergedCR.Example

HyperConvergedmanifest:apiVersion: hco.kubevirt.io/v1beta1 kind: HyperConverged metadata: name: kubevirt-hyperconverged namespace: openshift-cnv spec: liveMigrationConfig: completionTimeoutPerGiB: 800 network: <network> parallelMigrationsPerCluster: 5 parallelOutboundMigrationsPerNode: 2 progressTimeout: 150 # ...-

spec.liveMigrationConfig.networkdefines the name of the MultusNetworkAttachmentDefinitionobject to be used for live migrations.

-

-

Save your changes and exit the editor. The

virt-handlerpods restart and connect to the secondary network.

Verification

When the node that the virtual machine runs on is placed into maintenance mode, the VM automatically migrates to another node in the cluster. You can verify that the migration occurred over the secondary network and not the default pod network by checking the target IP address in the virtual machine instance (VMI) metadata.

$ oc get vmi <vmi_name> -o jsonpath='{.status.migrationState.targetNodeAddress}'

You can select a dedicated network for live migration by using the Red Hat OpenShift Service on AWS web console.

Prerequisites

- You configured a Multus network for live migration.

- You created a network attachment definition for the network.

Procedure

- Go to Virtualization > Overview in the Red Hat OpenShift Service on AWS web console.

- Click the Settings tab and then click Live migration.

- Select the network from the Live migration network list.

You can enable the creation of load balancer services for a virtual machine (VM) by using the Red Hat OpenShift Service on AWS web console.

Prerequisites

- You have configured a load balancer for the cluster.

-

You have logged in as a user with the

cluster-adminrole. - You created a network attachment definition for the network.

Procedure

- Go to Virtualization → Overview.

- On the Settings tab, click Cluster.

- Expand General settings and SSH configuration.

- Set SSH over LoadBalancer service to on.

As a cluster administrator, you can configure additional routes to the cdi-uploadproxy service, enabling users to upload virtual machine images from outside the cluster.

Prerequisites

-

You installed the OpenShift CLI (

oc). -

You logged in to the cluster as a user with the

cluster-adminrole.

Procedure

Configure the route to the external host by running the following command:

$ oc create route reencrypt <route_name> -n openshift-cnv \ --insecure-policy=Redirect \ --hostname=<host_name_or_address> \ --service=cdi-uploadproxywhere:

<route_name>- Specifies the name to assign to this custom route.

<host_name_or_address>- Specifies the fully qualified domain name or IP address of the external host providing image upload access.

Run the following command to annotate the route. This ensures that the correct Containerized Data Importer (CDI) CA certificate is injected when certificates are rotated:

$ oc annotate route <route_name> -n openshift-cnv \ operator.cdi.kubevirt.io/injectUploadProxyCert="true"where:

<route_name>- Specifies the name of the route you created.

4.4. Postinstallation storage configuration

If your storage provider is not recognized by the Containerized Data Importer (CDI), you must configure storage profiles after you install OpenShift Virtualization. Storage profiles provide recommended storage settings based on the associated storage class.

Optional: You can configure local storage by using the hostpath provisioner (HPP).

See the "Storage configuration overview" documentation for more options, including configuring the CDI, data volumes, and automatic boot source updates.

4.4.1. Configuring local storage by using the HPP

When you install the OpenShift Virtualization Operator, the Hostpath Provisioner (HPP) Operator is automatically installed. The HPP Operator creates the HPP provisioner.

The HPP is a local storage provisioner designed for OpenShift Virtualization. To use the HPP, you must create an HPP custom resource (CR).

HPP storage pools must not be in the same partition as the operating system. Otherwise, the storage pools might fill the operating system partition. If the operating system partition is full, this might negatively impact performance, or the node can become unstable or unusable.

To use the hostpath provisioner (HPP) you must create an associated storage class for the Container Storage Interface (CSI) driver.

When you create a storage class, you set parameters that affect the dynamic provisioning of persistent volumes (PVs) that belong to that storage class. You cannot update a StorageClass object’s parameters after you create it.

Procedure

Create a

storageclass_csi.yamlfile to define the storage class:apiVersion: storage.k8s.io/v1 kind: StorageClass metadata: name: hostpath-csi provisioner: kubevirt.io.hostpath-provisioner reclaimPolicy: Delete volumeBindingMode: WaitForFirstConsumer parameters: storagePool: my-storage-pool-

reclaimPolicydefines whether the underlying storage is deleted or retained when a user deletes a PVC. The two possiblereclaimPolicyvalues areDeleteandRetain. If you do not specify a value, the default value isDelete. volumeBindingModedefines the timing of PV creation. In this example, theWaitForFirstConsumerconfiguration delays PV creation until the scheduler assigns a pod to a specific node.NoteVirtual machines use data volumes based on local PVs, which reside on specific nodes. When the system prepares a disk image for the virtual machine, the scheduler might not place the virtual machine on the node where it pinned the local storage PV.

+ To solve this problem, use the Kubernetes pod scheduler to bind the persistent volume claim (PVC) to a PV on the correct node. Setting the

volumeBindingModeparameter of theStorageClasstoWaitForFirstConsumerdelays PV binding and provisioning until you create a pod that uses the PVC.-

parameters.storagePooldefines the name of the storage pool defined in the HPP custom resource (CR).

-

- Save the file and exit.

Create the

StorageClassobject by running the following command:$ oc create -f storageclass_csi.yaml

4.5. Configuring certificate rotation

Configure certificate rotation parameters to replace existing certificates.

4.5.1. Configuring certificate rotation

You can do this during OpenShift Virtualization installation in the web console or after installation in the HyperConverged custom resource (CR).

Prerequisites

-

You have installed the OpenShift CLI (

oc).

Procedure

Open the

HyperConvergedCR by running the following command:$ oc edit hyperconverged kubevirt-hyperconverged -n openshift-cnvEdit the

spec.certConfigfields as shown in the following example. To avoid overloading the system, ensure that all values are greater than or equal to 10 minutes. Express all values as strings that comply with the golangParseDurationformat.apiVersion: hco.kubevirt.io/v1beta1 kind: HyperConverged metadata: name: kubevirt-hyperconverged namespace: openshift-cnv spec: certConfig: ca: duration: 48h0m0s renewBefore: 24h0m0s server: duration: 24h0m0s renewBefore: 12h0m0s-

The value of

ca.renewBeforemust be less than or equal to the value ofca.duration. -

The value of

server.durationmust be less than or equal to the value ofca.duration. -

The value of

server.renewBeforemust be less than or equal to the value ofserver.duration.

-

The value of

Apply updates to the

HyperConvergedCR by running the following command:$ oc apply -f <filename>.yamlFor example:

$ oc apply -f kubevirt-hyperconverged.yaml

4.5.2. Troubleshooting certificate rotation parameters

Deleting one or more certConfig values in the HyperConverged custom resource (CR) causes the certConfig values to revert to the default values.

If the default values conflict with one of the following conditions, you receive an error message instead:

-

The value of

ca.renewBeforemust be less than or equal to the value ofca.duration. -

The value of

server.durationmust be less than or equal to the value ofca.duration. -

The value of

server.renewBeforemust be less than or equal to the value ofserver.duration.

For example, if you remove the server.duration value, the default value of 24h0m0s is greater than the value of ca.duration, which conflicts with the specified conditions:

apiVersion: hco.kubevirt.io/v1beta1

kind: HyperConverged

metadata:

name: kubevirt-hyperconverged

namespace: openshift-cnv

spec:

# ...

certConfig:

ca:

duration: 4h0m0s

renewBefore: 1h0m0s

server:

duration: 4h0m0s

renewBefore: 4h0m0s

# ...This results in the following error message:

error: hyperconvergeds.hco.kubevirt.io "kubevirt-hyperconverged" could not be patched: admission webhook "validate-hco.kubevirt.io" denied the request: spec.certConfig: ca.duration is smaller than server.duration

The error message only mentions the first conflict. Review all certConfig values before you proceed.

Chapter 5. Updating

5.1. Updating OpenShift Virtualization

Learn how to keep OpenShift Virtualization updated and compatible with Red Hat OpenShift Service on AWS.

5.1.1. About updating OpenShift Virtualization

When you install OpenShift Virtualization, you select an update channel and an approval strategy. The update channel determines the version of OpenShift Virtualization that you use. The approval strategy determines whether updates occur automatically or require manual approval. Both settings affect supportability.

5.1.1.1. Recommended settings

To keep a supportable environment, use the following settings:

- Update channel: stable

- Approval strategy: Automatic

Most OpenShift Virtualization installations use the stable release channel and the Automatic approval strategy. Use other settings only if you understand the risks.

With these settings, the update process starts automatically when a new Operator version is available in the stable channel. This keeps OpenShift Virtualization and Red Hat OpenShift Service on AWS versions compatible and ensures that OpenShift Virtualization is suitable for production environments.

Each minor version of OpenShift Virtualization is supported only with the corresponding Red Hat OpenShift Service on AWS version. For example, you must run OpenShift Virtualization 4.21 on Red Hat OpenShift Service on AWS 4.21.

5.1.1.2. What to expect

You can expect consistent update behavior in OpenShift Virtualization, including duration, automation, and data preservation.

- The time required to complete an update depends on your network connection. Most automatic updates complete within fifteen minutes.

- Updating OpenShift Virtualization does not interrupt network connections.

- An update preserves data volumes and their associated persistent volume claims.

If virtual machines use AWS Elastic Block Store (EBS) storage, they cannot be live migrated and might block an Red Hat OpenShift Service on AWS cluster update.

As a workaround, reconfigure the virtual machines so they can power off automatically during a cluster update. Set the evictionStrategy field to None and the runStrategy field to Always.

5.1.1.3. How updates work

Learn how Operator Lifecycle Manager (OLM) updates the OpenShift Virtualization Operator and how update channels and approval strategies affect upgrade behavior.

- Operator Lifecycle Manager (OLM) manages the lifecycle of the OpenShift Virtualization Operator. The Marketplace Operator, deployed during Red Hat OpenShift Service on AWS installation, makes external Operators available to your cluster.

- OLM provides z-stream and minor version updates for OpenShift Virtualization. Minor version updates become available when you update Red Hat OpenShift Service on AWS to the next minor version. You cannot update OpenShift Virtualization to the next minor version without first updating Red Hat OpenShift Service on AWS.

5.1.1.4. Changing update settings

You can control how and when updates are installed by changing the update channel and approval strategy for the OpenShift Virtualization Operator subscription.

Prerequisites

- You have installed the OpenShift Virtualization Operator.

- You have logged in to the Red Hat OpenShift Service on AWS web console as a cluster administrator.

Procedure

- Click Ecosystem → Installed Operators.

- Select OpenShift Virtualization from the list.

- Click the Subscription tab.

- In the Subscription details section, click the setting that you want to change. For example, to change the approval strategy from Manual to Automatic, click Manual.

- In the window that opens, select the new update channel or approval strategy.

- Click Save.

5.1.1.5. Manual approval strategy

If you use the Manual approval strategy, you must approve every pending update. If Red Hat OpenShift Service on AWS and OpenShift Virtualization updates are out of sync, your cluster becomes unsupported.

To avoid risk to cluster supportability and functionality, use the Automatic approval strategy. If you must use the Manual approval strategy, approve pending Operator updates as soon as they become available.

5.1.1.6. Manually approving a pending Operator update

If an installed Operator has the approval strategy in its subscription set to Manual, when new updates are released in its current update channel, the update must be manually approved before installation can begin.

Prerequisites

- An Operator previously installed using Operator Lifecycle Manager (OLM).

Procedure

- In the Red Hat OpenShift Service on AWS web console, navigate to Ecosystem → Installed Operators.

- Operators that have a pending update display a status with Upgrade available. Click the name of the Operator you want to update.

- Click the Subscription tab. Any updates requiring approval are displayed next to Upgrade status. For example, it might display 1 requires approval.

- Click 1 requires approval, then click Preview Install Plan.

- Review the resources that are listed as available for update. When satisfied, click Approve.

- Navigate back to the Ecosystem → Installed Operators page to monitor the progress of the update. When complete, the status changes to Succeeded and Up to date.

5.1.2. Remove unused Operators and resources

When updating OpenShift Virtualization to version 4.21, you can remove certain Operators and resources that are no longer required. This helps reclaim space and resources on your cluster.

5.1.3. RHEL 9 compatibility

OpenShift Virtualization 4.21 is based on Red Hat Enterprise Linux (RHEL) 9.

5.1.3.1. RHEL 9 machine type

All VM templates that are included with OpenShift Virtualization now use the RHEL 9 machine type by default: machineType: pc-q35-rhel9.<y>.0, where <y> is a single digit corresponding to the latest minor version of RHEL 9. For example, the value pc-q35-rhel9.2.0 is used for RHEL 9.2.

Updating OpenShift Virtualization does not change the machineType value of any existing VMs. These VMs continue to function as they did before the update. You can optionally change a VM’s machine type so that it can benefit from RHEL 9 improvements.

Before you change a VM’s machineType value, you must shut down the VM.

5.1.4. Monitoring update status

To monitor the status of a OpenShift Virtualization Operator update, watch the cluster service version (CSV) PHASE. You can also monitor the CSV conditions in the web console or by using the CLI.

The PHASE and conditions values are approximations that are based on available information.

Prerequisites

- You have logged in to the Red Hat OpenShift Service on AWS cluster as a cluster administrator.

-

You have installed the OpenShift CLI (

oc).

Procedure

Run the following command:

$ oc get csv -n openshift-cnvReview the output, checking the

PHASEfield. For example:VERSION REPLACES PHASE 4.9.0 kubevirt-hyperconverged-operator.v4.8.2 Installing 4.9.0 kubevirt-hyperconverged-operator.v4.9.0 ReplacingOptional: Monitor the aggregated status of all OpenShift Virtualization component conditions by running the following command: