지원

OpenShift Dedicated 지원

초록

1장. 지원 개요

Red Hat은 클러스터, 모니터링 및 문제 해결을 위한 클러스터 관리자 툴을 제공합니다.

1.1. 지원 받기

지원 받기: Red Hat 고객 포털을 방문하여 지식 베이스 문서를 검토하고, 지원 케이스를 제출하고, 추가 제품 설명서 및 리소스를 검토하십시오.

1.2. HO원격 상태 모니터링 문제

원격 상태 모니터링 문제: OpenShift Dedicated는 클러스터에 대한 Telemetry 및 구성 데이터를 수집하여 Telemeter Client 및 Insights Operator를 사용하여 Red Hat에 보고합니다. Red Hat은 이 데이터를 사용하여 연결된 클러스터 의 문제를 이해하고 해결합니다. OpenShift Dedicated는 다음을 사용하여 데이터 및 모니터 상태를 수집합니다.

Telemetry: Telemetry 클라이언트는 4분 30초마다 지표 값을 수집하여 Red Hat에 업로드합니다. Red Hat은 이 데이터를 사용하여 다음을 수행합니다.

- 클러스터를 모니터링합니다.

- OpenShift Dedicated 업그레이드를 롤아웃합니다.

- 업그레이드 환경을 개선합니다.

Insights Operator: 기본적으로 OpenShift Dedicated는 두 시간마다 구성 및 구성 요소 실패 상태를 보고하는 Insights Operator를 설치하고 활성화합니다. Insights Operator는 다음을 지원합니다.

- 잠재적인 클러스터 문제를 사전에 파악합니다.

- Red Hat OpenShift Cluster Manager에서 솔루션 및 예방 조치를 제공합니다.

Telemetry 정보를 검토 할 수 있습니다.

원격 상태 보고를 활성화한 경우 Red Hat Lightspeed를 사용하여 클러스터 문제를 식별합니다. 선택적으로 원격 상태 보고를 비활성화할 수 있습니다.

1.3. 클러스터에 대한 데이터 수집

클러스터에 대한 데이터 수집: 지원 케이스를 열 때 디버깅 정보를 수집할 것을 권장합니다. 이를 통해 Red Hat 지원은 근본 원인 분석을 수행할 수 있습니다. 클러스터 관리자는 다음을 사용하여 클러스터에 대한 데이터를 수집할 수 있습니다.

-

must-gather 툴:

must-gather툴을 사용하여 클러스터에 대한 정보를 수집하고 문제를 디버깅합니다. -

sosreport: 디버깅을 위해

sosreport툴을 사용하여 구성 세부 정보, 시스템 정보 및 진단 데이터를 수집합니다. - 클러스터 ID: Red Hat 지원에 정보를 제공할 때 클러스터의 고유 식별자를 가져옵니다.

-

클러스터 노드 저널 로그: 노드 관련 문제를 해결하기 위해 개별 클러스터 노드의

/var/log내에 있는journald장치 로그 및 로그입니다. - 네트워크 추적: 특정 OpenShift Dedicated 클러스터 노드 또는 컨테이너에서 Red Hat 지원으로 네트워크 패킷 추적을 제공하여 네트워크 관련 문제를 해결합니다.

1.4. 문제 해결

클러스터 관리자는 다음 OpenShift Dedicated 구성 요소 문제를 모니터링하고 해결할 수 있습니다.

노드 문제: 클러스터 관리자는 노드의 상태, 리소스 사용량 및 구성을 검토하여 노드 관련 문제를 확인하고 해결할 수 있습니다. 다음을 쿼리할 수 있습니다.

- 노드의 kubelet 상태입니다.

- 클러스터 노드 저널 로그입니다.

Operator 문제: 클러스터 관리자는 다음을 수행하여 Operator 문제를 해결할 수 있습니다.

- Operator 서브스크립션 상태를 확인합니다.

- Operator Pod 상태를 확인합니다.

- Operator 로그를 수집합니다.

Pod 문제: 클러스터 관리자는 Pod 상태를 검토하고 다음을 완료하여 Pod 관련 문제를 해결할 수 있습니다.

- Pod 및 컨테이너 로그를 검토합니다.

- root 액세스 권한으로 디버그 Pod를 시작합니다.

S2I 프로세스에서 오류가 발생한 위치를 확인하기 위해 클러스터 관리자는 S2I 단계를 관찰할 수 있습니다. 다음을 수집하여 S2I(Source-to-Image) 문제를 해결합니다.

- S2I(Source-to-Image) 진단 데이터입니다.

- 애플리케이션 오류를 조사하기 위한 애플리케이션 진단 데이터입니다.

스토리지 문제: 실패한 노드가 연결된 볼륨을 마운트 해제할 수 없기 때문에 새 노드의 마운트 볼륨이 불가능한 경우 다중 연결 스토리지 오류가 발생합니다. 클러스터 관리자는 다음을 수행하여 다중 연결 스토리지 문제를 해결할 수 있습니다.

- RWX 볼륨을 사용하여 여러 연결을 활성화합니다.

- RWO 볼륨을 사용할 때 오류가 발생한 노드를 복구하거나 삭제합니다.

모니터링 문제: 클러스터 관리자는 모니터링을 위해 문제 해결 페이지의 절차를 따를 수 있습니다. 사용자 정의 프로젝트의 지표를 사용할 수 없거나 Prometheus가 많은 디스크 공간을 사용하는 경우 다음을 확인하십시오.

- 사용자 정의 메트릭을 사용할 수 없는 이유를 조사합니다.

- Prometheus가 많은 디스크 공간을 소비하는 이유를 확인합니다.

-

OpenShift CLI(

oc) 문제: 로그 수준을 늘려 OpenShift CLI(oc) 문제 조사

2장. 클러스터 리소스 관리

OpenShift Dedicated에서 글로벌 구성 옵션을 적용할 수 있습니다. Operator는 이러한 구성 설정을 클러스터 전체에 적용합니다.

2.1. 클러스터 리소스와 상호 작용

OpenShift Dedicated에서 OpenShift CLI(oc) 툴을 사용하여 클러스터 리소스와 상호 작용할 수 있습니다. oc api-resources 명령을 실행한 후 표시되는 클러스터 리소스를 편집할 수 있습니다.

사전 요구 사항

-

dedicated-admin역할의 사용자로 클러스터에 액세스할 수 있습니다. -

웹 콘솔에 액세스하거나

ocCLI 툴을 설치했습니다.

프로세스

적용된 구성 Operator를 보려면 다음 명령을 실행합니다.

$ oc api-resources -o name | grep config.openshift.io구성할 수 있는 클러스터 리소스를 보려면 다음 명령을 실행합니다.

$ oc explain <resource_name>.config.openshift.io클러스터에서 CRD(사용자 정의 리소스 정의) 오브젝트의 구성을 보려면 다음 명령을 실행합니다.

$ oc get <resource_name>.config -o yaml클러스터 리소스 구성을 편집하려면 다음 명령을 실행합니다.

$ oc edit <resource_name>.config -o yaml

3장. 지원 요청

3.1. 지원 요청

이 문서에 설명된 절차 또는 일반적으로 OpenShift Dedicated에 어려움이 있는 경우 Red Hat 고객 포털 을 방문하십시오.

고객 포털에서 다음을 수행할 수 있습니다.

- Red Hat 제품과 관련된 기사 및 솔루션에 대한 Red Hat 지식베이스를 검색하거나 살펴볼 수 있습니다.

- Red Hat 지원에 대한 지원 케이스 제출할 수 있습니다.

- 다른 제품 설명서에 액세스 가능합니다.

클러스터 문제를 식별하기 위해 OpenShift Cluster Manager 에서 Red Hat Lightspeed를 사용할 수 있습니다. Red Hat Lightspeed는 문제에 대한 세부 정보와 가능한 경우 문제 해결 방법에 대한 정보를 제공합니다.

이 문서를 개선하기 위한 제안이 있거나 오류를 발견한 경우 가장 관련 문서 구성 요소에 대해 Jira 문제를 제출합니다. 섹션 이름 및 OpenShift Dedicated 버전과 같은 특정 세부 정보를 제공하십시오.

3.2. Red Hat 지식베이스 정보

Red Hat 지식베이스는 Red Hat의 제품과 기술을 최대한 활용할 수 있도록 풍부한 콘텐츠를 제공합니다. Red Hat 지식베이스는 Red Hat 제품 설치, 설정 및 사용에 대한 기사, 제품 문서 및 동영상으로 구성되어 있습니다. 또한 알려진 문제에 대한 솔루션을 검색할 수 있으며, 간결한 근본 원인 설명 및 해결 단계를 제공합니다.

3.3. Red Hat 지식베이스 검색

OpenShift Dedicated 문제가 있는 경우 초기 검색을 수행하여 솔루션이 이미 Red Hat 지식 베이스 내에 있는지 확인할 수 있습니다.

사전 요구 사항

- Red Hat 고객 포털 계정이 있어야 합니다.

프로세스

- Red Hat 고객 포털에 로그인합니다.

- Search를 클릭합니다

검색 필드에서 다음을 포함하여 문제와 관련된 키워드 및 문자열을 입력합니다.

- OpenShift Dedicated 구성 요소 (예: etcd)

- 관련 절차 (예: installation 등)

- 명시적 실패와 관련된 경고, 오류 메시지 및 기타 출력

- Enter 키를 클릭합니다.

- 선택 사항: OpenShift Dedicated 제품 필터를 선택합니다.

- 선택 사항: 문서 콘텐츠 유형 필터를 선택합니다.

3.4. 지원 케이스 제출

사전 요구 사항

-

dedicated-admin역할의 사용자로 클러스터에 액세스할 수 있습니다. -

OpenShift CLI(

oc)가 설치되어 있습니다. - Red Hat OpenShift Cluster Manager에 액세스할 수 있습니다.

프로세스

- Red Hat 고객 포털의 고객 지원 페이지에 로그인합니다.

- 지원 받기를 클릭합니다.

고객 지원 페이지의 케이스 탭에서 다음을 수행합니다.

- 선택 사항: 필요한 경우 미리 채워진 계정 및 소유자 세부 정보를 변경합니다.

- Bug 또는 Defect 와 같은 문제에 대한 적절한 카테고리를 선택하고 Continue 를 클릭합니다.

다음 정보를 입력합니다.

- 요약 필드에 간결하지만 설명적인 문제 요약을 입력하고 경험되는 증상에 대한 자세한 내용과 기대치를 입력합니다.

- 제품 드롭다운 메뉴에서 OpenShift Dedicated 를 선택합니다.

- 보고되는 문제와 관련이 있을 수 있는 권장 Red Hat 지식베이스 솔루션 목록을 확인합니다. 제안된 문서로 문제가 해결되지 않으면 Continue을 클릭합니다.

- 보고되는 문제와 관련있는 제안된 Red Hat 지식베이스 솔루션 목록을 확인하십시오. 케이스 작성 과정에서 더 많은 정보를 제공하면 목록이 구체화됩니다. 제안된 문서로 문제가 해결되지 않으면 Continue을 클릭합니다.

- 제시된 계정 정보가 정확한지 확인하고 필요한 경우 적절하게 수정합니다.

자동 입력된 OpenShift Dedicated 클러스터 ID가 올바른지 확인합니다. 그렇지 않은 경우 클러스터 ID를 수동으로 가져옵니다.

OpenShift Cluster Manager 를 사용하여 클러스터 ID를 수동으로 가져오려면 다음을 수행합니다.

- 클러스터 목록으로 이동합니다.

- 지원 케이스를 열어야 하는 클러스터 이름을 클릭합니다.

- 개요 탭의 세부 정보 섹션에 있는 Cluster ID 필드에서 값을 찾습니다.

OpenShift Dedicated 웹 콘솔을 사용하여 클러스터 ID를 수동으로 가져오려면 다음을 수행합니다.

- 홈 → 개요 로 이동합니다.

- Details 섹션의 Cluster ID 필드에서 값을 찾습니다.

또는 OpenShift Dedicated 웹 콘솔을 통해 새 지원 케이스를 열고 클러스터 ID를 자동으로 입력할 수 있습니다.

- 툴바에서 (?) Help → Open Support Case로 이동합니다.

- Cluster ID 값이 자동으로 입력됩니다.

OpenShift CLI (

oc)를 사용하여 클러스터 ID를 얻으려면 다음 명령을 실행합니다.$ oc get clusterversion -o jsonpath='{.items[].spec.clusterID}{"\n"}'

프롬프트가 표시되면 다음 질문을 입력한 후 Continue를 클릭합니다.

- 무엇을 경험하고 있습니까? 어떤 일이 발생할 것으로 예상하십니까?

- 귀하 또는 비즈니스에 미치는 영향 또는 가치를 정의합니다.

- 이 동작을 어디에서 경험하고 있습니까? 어떤 시스템 환경을 사용하고 있습니까?

- 이 동작이 언제 발생합니까? 발생 빈도는 어떻게 됩니까? 반복적으로 발생합니까? 특정 시간에만 발생합니까?

- 관련 진단 데이터 파일을 업로드하고 Continue를 클릭합니다.

- 관련 케이스 관리 세부 정보를 입력하고 Continue를 클릭합니다.

- 케이스 세부 정보를 미리보고 Submit을 클릭합니다.

4장. 클러스터에 연결하여 원격 상태 모니터링

4.1. 원격 상태 모니터링 정보

OpenShift Dedicated는 클러스터에 대한 Telemetry 및 구성 데이터를 수집하여 Telemeter Client 및 Insights Operator를 사용하여 Red Hat에 보고합니다. Red Hat에 제공되는 데이터는 이 문서에 설명된 이점을 제공합니다.

Telemetry 및 Insights Operator를 통해 Red Hat에 데이터를 보고하는 클러스터는 연결 클러스터(connected cluster)라고 합니다.

Telemetry 는 OpenShift Dedicated Telemeter Client에서 Red Hat으로 전송되는 정보를 설명하는 데 사용하는 용어입니다. 경량 속성은 연결된 클러스터에서 Red Hat으로 전송되어 서브스크립션 관리 자동화를 활성화하고, 클러스터의 상태를 모니터링하며, 지원 및 고객 환경을 개선합니다.

Insights Operator 는 OpenShift Dedicated 구성 데이터를 수집하여 Red Hat으로 보냅니다. 데이터는 클러스터가 노출될 수 있는 문제에 대한 통찰력을 생성하는 데 사용됩니다. 이러한 통찰력은 OpenShift Cluster Manager 에서 클러스터 관리자에게 전달됩니다.

이 두 프로세스에 대한 자세한 내용은 이 문서에 기재되어 있습니다.

Telemetry 및 Insights Operator의 이점

Telemetry 및 Insights Operator는 최종 사용자에게 다음과 같은 이점을 제공합니다.

- 문제 확인 및 해결 방법을 강화 Red Hat은 최종 사용자에 정상적으로 표시될 수 있는 이벤트를 클러스터 단위로 보다 광범위한 관점에서 확인할 수 있습니다. 일부 문제는 이러한 관점에서 보다 신속하게 확인하고 Jira 문제를 열거나 지원 케이스를 열 필요없이 최종 사용자가 해결 할 수 있습니다.

-

고급 릴리스 관리 OpenShift Dedicated는

후보,빠른및안정적인릴리스 채널을 제공하여 업데이트 전략을 선택할 수 있습니다. 릴리스를fast버전에서stable버전으로 업그레이드하는 것은 업데이트의 성공률 및 업그레이드 중에 발생하는 이벤트에 따라 달라집니다. 연결된 클러스터에서 제공하는 정보를 통해 Red Hat은 릴리스 품질을stable채널로 개선하고fast채널에 있는 문제에 신속하게 대응할 수 있습니다. - 새로운 기능 및 기능의 우선 순위를 지정 수집된 데이터는 OpenShift Dedicated의 가장 많이 사용되는 영역에 대한 통찰력을 제공합니다. 이러한 정보를 통해 Red Hat은 고객에게 가장 큰 영향을 미치는 새로운 기능 및 기능을 개발하는 데 중점을 둘 수 있습니다.

- 간소화된 지원 환경 제공 Red Hat 고객 포털에서 지원 티켓을 생성할 때 연결된 클러스터의 클러스터 ID를 지정할 수 있습니다. 이를 통해 Red Hat은 연결된 정보를 사용하여 클러스터 고유의 간소화된 지원 환경을 제공할 수 있습니다. 이 문서에서는 향상된 지원 환경에 대한 자세한 정보를 제공합니다.

- 예측 분석 OpenShift Cluster Manager 의 클러스터에 대해 표시되는 Insights는 연결된 클러스터에서 수집한 정보로 활성화됩니다. Red Hat은 OpenShift Dedicated 클러스터가 노출되는 문제를 식별하는 데 도움이 되도록 딥 러닝, 머신 러닝 및 인공 지능 자동화를 적용하는 데 투자하고 있습니다.

OpenShift Dedicated에서 원격 상태 보고는 항상 활성화됩니다. 이를 옵트아웃할 수 없습니다.

4.1.1. Telemetry 정보

Telemetry는 엄선된 클러스터 모니터링 지표의 일부를 Red Hat으로 보냅니다. Telemeter Client는 4분 30초마다 메트릭 값을 가져와 Red Hat에 데이터를 업로드합니다. 이러한 메트릭에 대한 설명은 이 설명서에서 제공됩니다.

Red Hat은 이러한 데이터 스트림을 사용하여 클러스터를 실시간으로 모니터링하고 필요에 따라 고객에게 영향을 미치는 문제에 대응합니다. 또한 Red Hat은 OpenShift Dedicated 업그레이드를 고객에게 제공하여 서비스 영향을 최소화하고 지속적으로 업그레이드 환경을 개선할 수 있습니다.

이러한 디버깅 정보는 Red Hat 지원 및 엔지니어링 팀에 제공되며, 지원 사례를 통해 보고된 데이터에 액세스하는 것과 동일한 제한 사항이 적용됩니다. Red Hat은 연결된 모든 클러스터 정보를 사용하여 OpenShift Dedicated를 개선하고 보다 직관적으로 사용할 수 있도록 지원합니다.

4.1.1.1. Telemetry에서 수집하는 정보

Telemetry에서 수집되는 정보는 다음과 같습니다.

4.1.1.1.1. 시스템 정보

- OpenShift Dedicated 클러스터 버전 및 업데이트 버전 가용성 확인에 사용되는 업데이트 세부 정보를 포함한 버전 정보

- 클러스터당 사용 가능한 업데이트 수, 업데이트 진행 정보, 업데이트 진행 정보에 사용되는 채널 및 이미지 리포지터리, 업데이트에 발생하는 오류 수를 포함한 업데이트 정보

- 설치 중 생성된 임의의 고유 식별자

- Red Hat 지원이 클라우드 인프라 수준, 호스트 이름, IP 주소, Kubernetes Pod 이름, 네임스페이스 및 서비스의 노드 구성을 포함하여 고객에게 유용한 지원을 제공하는 데 도움이 되는 구성 세부 정보

- 클러스터 및 해당 조건 및 상태에 설치된 OpenShift Dedicated 프레임워크 구성 요소

- 성능이 저하된 Operator에 대해 "관련 개체"로 나열된 모든 네임스페이스에 대한 이벤트

- 성능 저하 소프트웨어에 대한 정보

- 인증서의 유효성에 대한 정보

- OpenShift Dedicated가 배포된 공급자 플랫폼의 이름 및 데이터 센터 위치

4.1.1.1.2. 크기 조정 정보

- CPU 코어 수 및 각각에 사용된 RAM 용량을 포함한 클러스터, 시스템 유형 및 머신 크기에 대한 정보

- etcd 멤버 수 및 etcd 클러스터에 저장된 오브젝트 수

4.1.1.1.3. 사용 정보

- 구성 요소, 기능 및 확장에 대한 사용 정보

- 기술 프리뷰 및 지원되지 않는 구성에 대한 사용량 세부 정보

Telemetry에서는 사용자 이름 또는 암호와 같은 식별 정보를 수집하지 않습니다. Red Hat은 개인 정보를 수집하지 않습니다. 개인 정보가 의도하지 않게 Red Hat에 수신된 경우 Red Hat은 이러한 정보를 삭제합니다. Telemetry 데이터가 개인 정보를 구성하는 범위까지, Red Hat의 개인정보 보호정책에 대한 자세한 내용은 Red Hat 개인정보처리방침을 참조하십시오.

4.1.1.2. 사용자 Telemetry

Red Hat은 귀하의 브라우저에서 익명화된 사용자 데이터를 수집합니다. 이 익명화된 데이터에는 Telemetry가 활성화된 모든 클러스터의 사용자가 사용하는 페이지, 기능 및 리소스 유형이 포함됩니다.

기타 고려 사항:

- 사용자 이벤트는 SHA-1 해시로 그룹화됩니다.

-

사용자의 IP 주소는

0.0.0.0으로 저장됩니다. - 사용자 이름과 IP 주소는 별도의 값으로 저장되지 않습니다.

4.1.2. Insights Operator 정보

Insights Operator는 구성 및 구성 요소 오류 상태를 주기적으로 수집하고 기본적으로 2시간마다 데이터를 Red Hat에 보고합니다. Red Hat은 이러한 정보를 통해 구성 및 Telemetry를 통해 보고된 것보다 더 깊은 오류 데이터를 평가할 수 있습니다.

OpenShift Dedicated 사용자는 Red Hat Hybrid Cloud Console의 Advisor 서비스에서 각 클러스터의 보고서를 표시할 수 있습니다. 문제가 확인된 경우 Red Hat Lightspeed는 추가 세부 정보와 가능한 경우 문제 해결 방법에 대한 단계를 제공합니다.

Insights Operator는 사용자 이름, 암호 또는 인증서와 같은 식별 정보를 수집하지 않습니다. Red Hat Lightspeed 데이터 수집 및 제어에 대한 정보는 Red Hat Lightspeed Data & Application Security 에서 참조하십시오.

Red Hat은 연결된 모든 클러스터 정보를 사용하여 다음을 수행합니다.

- 잠재적인 클러스터 문제를 식별하고 Red Hat Hybrid Cloud Console의 Advisor 서비스에서 해결 및 예방 조치 제공

- 제품 및 지원 팀에 집계되고 중요한 정보를 제공하여 OpenShift Dedicated 개선

- OpenShift Dedicated를 보다 직관적으로 설정

4.1.2.1. Insights Operator에 의해 수집되는 정보

Insights Operator에서 수집되는 정보는 다음과 같습니다.

- OpenShift Dedicated 버전 및 환경과 관련된 문제를 식별하는 클러스터 및 해당 구성 요소에 대한 일반 정보입니다.

- 설정한 매개변수와 관련된 잘못된 설정 및 문제를 확인하기 위해 클러스터의 이미지 레지스트리 구성과 같은 구성 파일입니다.

- 클러스터 구성 요소에서 발생하는 오류입니다.

- 실행 중인 업데이트의 진행 상황 정보 및 구성 요소의 업그레이드 상태입니다.

- OpenShift Dedicated가 배포된 플랫폼 및 클러스터가 있는 리전의 세부 정보

-

Operator에서 문제를 보고하면

openshift-*및kube-*프로젝트의 핵심 OpenShift Dedicated Pod에 대한 정보가 수집됩니다. 여기에는 상태, 리소스, 보안 컨텍스트, 볼륨 정보 등이 포함됩니다.

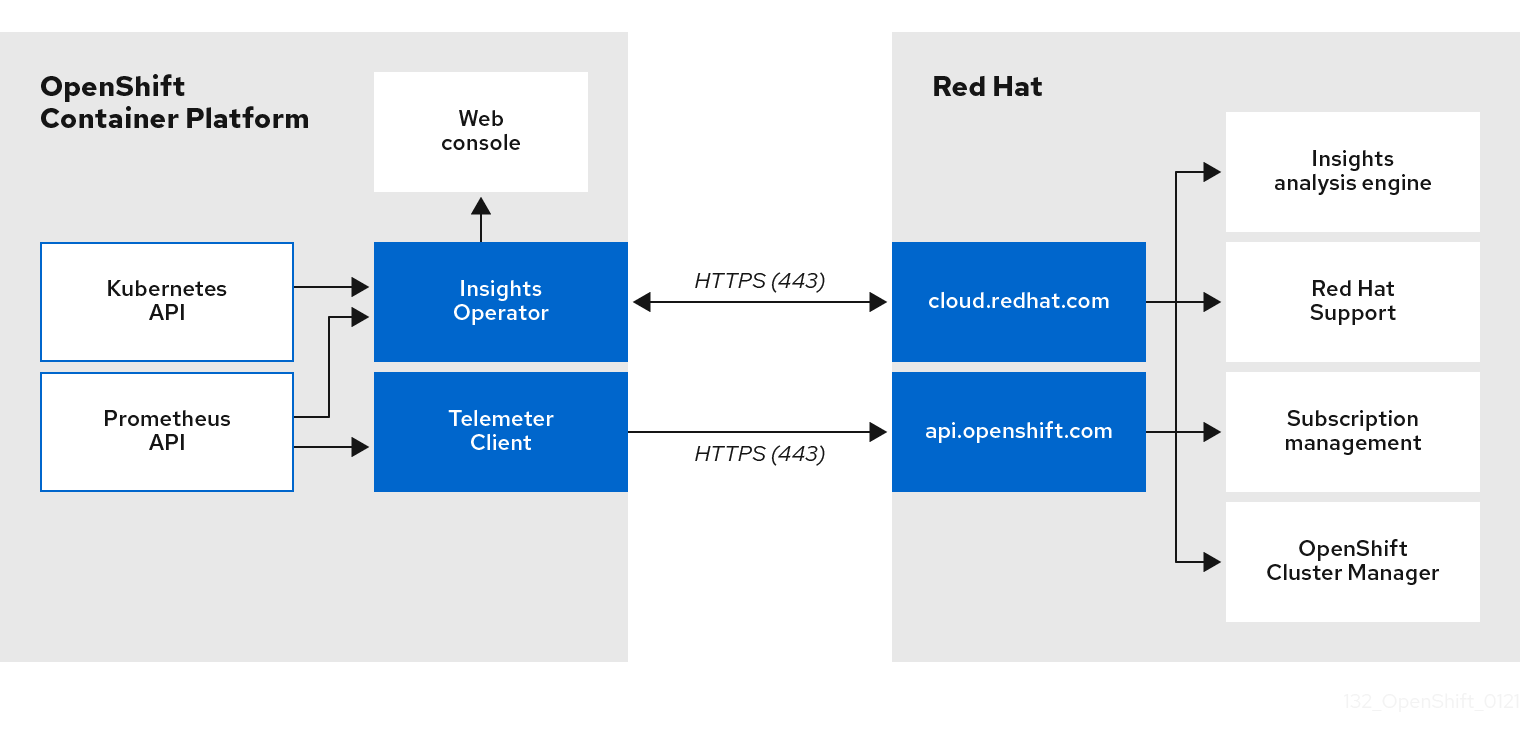

4.1.3. Telemetry 및 Insights Operator 데이터 흐름 이해

Telemeter Client는 Prometheus API에서 선택한 시계열 데이터를 수집합니다. 시계열 데이터는 처리하기 위해 4분 30초 마다 api.openshift.com에 업로드됩니다.

Insights Operator는 선택한 데이터를 Kubernetes API 및 Prometheus API에서 아카이브로 수집합니다. 아카이브는 처리를 위해 2시간마다 OpenShift Cluster Manager 에 업로드됩니다. 또한 Insights Operator는 OpenShift Cluster Manager 에서 최신 Red Hat Lightspeed 분석을 다운로드합니다. OpenShift Dedicated 웹 콘솔의 개요 페이지에 포함된 Red Hat Lightspeed 상태 팝업을 채우는 데 사용됩니다.

Red Hat과의 모든 통신은 TLS(Transport Layer Security) 및 상호 인증서 인증을 사용하여 암호화된 채널을 통해 이루어집니다. 모든 데이터는 전송 및 정지 상태에서 암호화됩니다.

고객 데이터를 처리하는 시스템에 대한 액세스는 다단계 인증 및 엄격한 인증 권한에 의해 제어됩니다. 필요에 따라 액세스 권한이 부여되며 필수 작업으로 제한됩니다.

Telemetry 및 Insights Operator 데이터 흐름

4.1.4. 원격 상태 모니터링 데이터 사용 방법에 대한 추가 정보

원격 상태 모니터링을 사용하도록 수집된 정보는 Telemetry에 의해 수집된 정보 및 Insights Operator에 의해 수집된 정보에서 참조하십시오.

이 문서의 이전 섹션에 설명되어 있듯이 Red Hat은 지원 및 업그레이드, 성능 또는 구성 최적화, 서비스에 미치는 영향을 최소화, 위협 식별 및 문제 해결, 문제에 대한 대응 및 청구 등의 목적으로 Red Hat 제품 사용에 대한 데이터를 수집합니다.

수집 보안 조치

Red Hat은 Telemetry 및 구성 데이터를 보호하기 위해 설계된 기술 및 제도 상의 조치를 사용합니다.

공유

Red Hat은 사용자 환경을 개선하기 위해 Telemetry 및 Insights Operator를 통해 수집한 데이터를 내부적으로 공유할 수 있습니다. Red Hat은 파트너가 시장과 고객의 Red Hat 제품 사용을 더 잘 이해할 수 있도록 지원하거나 파트너가 공동으로 지원하는 제품을 성공적으로 통합할 수 있도록 고객을 식별할 수 없는 집계 형태로 Telemetry 및 구성 데이터를 공유할 수 있습니다.

타사

Red Hat은 Telemetry 및 구성 데이터의 수집, 분석 및 저장을 지원하기 위해 특정 타사와 협력할 수 있습니다.

4.2. 원격 상태 모니터링으로 수집된 데이터 표시

사용자 컨트롤 / Telemetry 및 설정 데이터 수집 활성화 및 비활성화

관리자는 Telemetry 및 Insights Operator에서 수집한 메트릭을 검토할 수 있습니다.

4.2.1. Telemetry로 수집한 데이터 표시

Telemetry에서 캡처한 클러스터 및 구성 요소 시계열 데이터를 볼 수 있습니다.

사전 요구 사항

-

OpenShift Container Platform CLI(

oc)를 설치했습니다. -

dedicated-admin역할의 사용자로 클러스터에 액세스할 수 있습니다.

프로세스

- 클러스터에 로그인합니다.

- 다음 명령을 실행하여 클러스터의 Prometheus 서비스를 쿼리하고 Telemetry에서 캡처한 전체 시계열 데이터 세트를 반환합니다.

다음 예제에는 AWS의 OpenShift Dedicated와 관련된 몇 가지 값이 포함되어 있습니다.

$ curl -G -k -H "Authorization: Bearer $(oc whoami -t)" \

https://$(oc get route prometheus-k8s-federate -n \

openshift-monitoring -o jsonpath="{.spec.host}")/federate \

--data-urlencode 'match[]={__name__=~"cluster:usage:.*"}' \

--data-urlencode 'match[]={__name__="count:up0"}' \

--data-urlencode 'match[]={__name__="count:up1"}' \

--data-urlencode 'match[]={__name__="cluster_version"}' \

--data-urlencode 'match[]={__name__="cluster_version_available_updates"}' \

--data-urlencode 'match[]={__name__="cluster_version_capability"}' \

--data-urlencode 'match[]={__name__="cluster_operator_up"}' \

--data-urlencode 'match[]={__name__="cluster_operator_conditions"}' \

--data-urlencode 'match[]={__name__="cluster_version_payload"}' \

--data-urlencode 'match[]={__name__="cluster_installer"}' \

--data-urlencode 'match[]={__name__="cluster_infrastructure_provider"}' \

--data-urlencode 'match[]={__name__="cluster_feature_set"}' \

--data-urlencode 'match[]={__name__="instance:etcd_object_counts:sum"}' \

--data-urlencode 'match[]={__name__="ALERTS",alertstate="firing"}' \

--data-urlencode 'match[]={__name__="code:apiserver_request_total:rate:sum"}' \

--data-urlencode 'match[]={__name__="cluster:capacity_cpu_cores:sum"}' \

--data-urlencode 'match[]={__name__="cluster:capacity_memory_bytes:sum"}' \

--data-urlencode 'match[]={__name__="cluster:cpu_usage_cores:sum"}' \

--data-urlencode 'match[]={__name__="cluster:memory_usage_bytes:sum"}' \

--data-urlencode 'match[]={__name__="openshift:cpu_usage_cores:sum"}' \

--data-urlencode 'match[]={__name__="openshift:memory_usage_bytes:sum"}' \

--data-urlencode 'match[]={__name__="workload:cpu_usage_cores:sum"}' \

--data-urlencode 'match[]={__name__="workload:memory_usage_bytes:sum"}' \

--data-urlencode 'match[]={__name__="cluster:virt_platform_nodes:sum"}' \

--data-urlencode 'match[]={__name__="cluster:node_instance_type_count:sum"}' \

--data-urlencode 'match[]={__name__="cnv:vmi_status_running:count"}' \

--data-urlencode 'match[]={__name__="cluster:vmi_request_cpu_cores:sum"}' \

--data-urlencode 'match[]={__name__="node_role_os_version_machine:cpu_capacity_cores:sum"}' \

--data-urlencode 'match[]={__name__="node_role_os_version_machine:cpu_capacity_sockets:sum"}' \

--data-urlencode 'match[]={__name__="subscription_sync_total"}' \

--data-urlencode 'match[]={__name__="olm_resolution_duration_seconds"}' \

--data-urlencode 'match[]={__name__="csv_succeeded"}' \

--data-urlencode 'match[]={__name__="csv_abnormal"}' \

--data-urlencode 'match[]={__name__="cluster:kube_persistentvolumeclaim_resource_requests_storage_bytes:provisioner:sum"}' \

--data-urlencode 'match[]={__name__="cluster:kubelet_volume_stats_used_bytes:provisioner:sum"}' \

--data-urlencode 'match[]={__name__="ceph_cluster_total_bytes"}' \

--data-urlencode 'match[]={__name__="ceph_cluster_total_used_raw_bytes"}' \

--data-urlencode 'match[]={__name__="ceph_health_status"}' \

--data-urlencode 'match[]={__name__="odf_system_raw_capacity_total_bytes"}' \

--data-urlencode 'match[]={__name__="odf_system_raw_capacity_used_bytes"}' \

--data-urlencode 'match[]={__name__="odf_system_health_status"}' \

--data-urlencode 'match[]={__name__="job:ceph_osd_metadata:count"}' \

--data-urlencode 'match[]={__name__="job:kube_pv:count"}' \

--data-urlencode 'match[]={__name__="job:odf_system_pvs:count"}' \

--data-urlencode 'match[]={__name__="job:ceph_pools_iops:total"}' \

--data-urlencode 'match[]={__name__="job:ceph_pools_iops_bytes:total"}' \

--data-urlencode 'match[]={__name__="job:ceph_versions_running:count"}' \

--data-urlencode 'match[]={__name__="job:noobaa_total_unhealthy_buckets:sum"}' \

--data-urlencode 'match[]={__name__="job:noobaa_bucket_count:sum"}' \

--data-urlencode 'match[]={__name__="job:noobaa_total_object_count:sum"}' \

--data-urlencode 'match[]={__name__="odf_system_bucket_count", system_type="OCS", system_vendor="Red Hat"}' \

--data-urlencode 'match[]={__name__="odf_system_objects_total", system_type="OCS", system_vendor="Red Hat"}' \

--data-urlencode 'match[]={__name__="noobaa_accounts_num"}' \

--data-urlencode 'match[]={__name__="noobaa_total_usage"}' \

--data-urlencode 'match[]={__name__="console_url"}' \

--data-urlencode 'match[]={__name__="cluster:ovnkube_master_egress_routing_via_host:max"}' \

--data-urlencode 'match[]={__name__="cluster:network_attachment_definition_instances:max"}' \

--data-urlencode 'match[]={__name__="cluster:network_attachment_definition_enabled_instance_up:max"}' \

--data-urlencode 'match[]={__name__="cluster:ingress_controller_aws_nlb_active:sum"}' \

--data-urlencode 'match[]={__name__="cluster:route_metrics_controller_routes_per_shard:min"}' \

--data-urlencode 'match[]={__name__="cluster:route_metrics_controller_routes_per_shard:max"}' \

--data-urlencode 'match[]={__name__="cluster:route_metrics_controller_routes_per_shard:avg"}' \

--data-urlencode 'match[]={__name__="cluster:route_metrics_controller_routes_per_shard:median"}' \

--data-urlencode 'match[]={__name__="cluster:openshift_route_info:tls_termination:sum"}' \

--data-urlencode 'match[]={__name__="insightsclient_request_send_total"}' \

--data-urlencode 'match[]={__name__="cam_app_workload_migrations"}' \

--data-urlencode 'match[]={__name__="cluster:apiserver_current_inflight_requests:sum:max_over_time:2m"}' \

--data-urlencode 'match[]={__name__="cluster:alertmanager_integrations:max"}' \

--data-urlencode 'match[]={__name__="cluster:telemetry_selected_series:count"}' \

--data-urlencode 'match[]={__name__="openshift:prometheus_tsdb_head_series:sum"}' \

--data-urlencode 'match[]={__name__="openshift:prometheus_tsdb_head_samples_appended_total:sum"}' \

--data-urlencode 'match[]={__name__="monitoring:container_memory_working_set_bytes:sum"}' \

--data-urlencode 'match[]={__name__="namespace_job:scrape_series_added:topk3_sum1h"}' \

--data-urlencode 'match[]={__name__="namespace_job:scrape_samples_post_metric_relabeling:topk3"}' \

--data-urlencode 'match[]={__name__="monitoring:haproxy_server_http_responses_total:sum"}' \

--data-urlencode 'match[]={__name__="rhmi_status"}' \

--data-urlencode 'match[]={__name__="status:upgrading:version:rhoam_state:max"}' \

--data-urlencode 'match[]={__name__="state:rhoam_critical_alerts:max"}' \

--data-urlencode 'match[]={__name__="state:rhoam_warning_alerts:max"}' \

--data-urlencode 'match[]={__name__="rhoam_7d_slo_percentile:max"}' \

--data-urlencode 'match[]={__name__="rhoam_7d_slo_remaining_error_budget:max"}' \

--data-urlencode 'match[]={__name__="cluster_legacy_scheduler_policy"}' \

--data-urlencode 'match[]={__name__="cluster_master_schedulable"}' \

--data-urlencode 'match[]={__name__="che_workspace_status"}' \

--data-urlencode 'match[]={__name__="che_workspace_started_total"}' \

--data-urlencode 'match[]={__name__="che_workspace_failure_total"}' \

--data-urlencode 'match[]={__name__="che_workspace_start_time_seconds_sum"}' \

--data-urlencode 'match[]={__name__="che_workspace_start_time_seconds_count"}' \

--data-urlencode 'match[]={__name__="cco_credentials_mode"}' \

--data-urlencode 'match[]={__name__="cluster:kube_persistentvolume_plugin_type_counts:sum"}' \

--data-urlencode 'match[]={__name__="visual_web_terminal_sessions_total"}' \

--data-urlencode 'match[]={__name__="acm_managed_cluster_info"}' \

--data-urlencode 'match[]={__name__="cluster:vsphere_vcenter_info:sum"}' \

--data-urlencode 'match[]={__name__="cluster:vsphere_esxi_version_total:sum"}' \

--data-urlencode 'match[]={__name__="cluster:vsphere_node_hw_version_total:sum"}' \

--data-urlencode 'match[]={__name__="openshift:build_by_strategy:sum"}' \

--data-urlencode 'match[]={__name__="rhods_aggregate_availability"}' \

--data-urlencode 'match[]={__name__="rhods_total_users"}' \

--data-urlencode 'match[]={__name__="instance:etcd_disk_wal_fsync_duration_seconds:histogram_quantile",quantile="0.99"}' \

--data-urlencode 'match[]={__name__="instance:etcd_mvcc_db_total_size_in_bytes:sum"}' \

--data-urlencode 'match[]={__name__="instance:etcd_network_peer_round_trip_time_seconds:histogram_quantile",quantile="0.99"}' \

--data-urlencode 'match[]={__name__="instance:etcd_mvcc_db_total_size_in_use_in_bytes:sum"}' \

--data-urlencode 'match[]={__name__="instance:etcd_disk_backend_commit_duration_seconds:histogram_quantile",quantile="0.99"}' \

--data-urlencode 'match[]={__name__="appsvcs:cores_by_product:sum"}' \

--data-urlencode 'match[]={__name__="nto_custom_profiles:count"}' \

--data-urlencode 'match[]={__name__="openshift_csi_share_configmap"}' \

--data-urlencode 'match[]={__name__="openshift_csi_share_secret"}' \

--data-urlencode 'match[]={__name__="openshift_csi_share_mount_failures_total"}' \

--data-urlencode 'match[]={__name__="openshift_csi_share_mount_requests_total"}' \

--data-urlencode 'match[]={__name__="cluster:velero_backup_total:max"}' \

--data-urlencode 'match[]={__name__="cluster:velero_restore_total:max"}' \

--data-urlencode 'match[]={__name__="eo_es_storage_info"}' \

--data-urlencode 'match[]={__name__="eo_es_redundancy_policy_info"}' \

--data-urlencode 'match[]={__name__="eo_es_defined_delete_namespaces_total"}' \

--data-urlencode 'match[]={__name__="eo_es_misconfigured_memory_resources_info"}' \

--data-urlencode 'match[]={__name__="cluster:eo_es_data_nodes_total:max"}' \

--data-urlencode 'match[]={__name__="cluster:eo_es_documents_created_total:sum"}' \

--data-urlencode 'match[]={__name__="cluster:eo_es_documents_deleted_total:sum"}' \

--data-urlencode 'match[]={__name__="pod:eo_es_shards_total:max"}' \

--data-urlencode 'match[]={__name__="eo_es_cluster_management_state_info"}' \

--data-urlencode 'match[]={__name__="imageregistry:imagestreamtags_count:sum"}' \

--data-urlencode 'match[]={__name__="imageregistry:operations_count:sum"}' \

--data-urlencode 'match[]={__name__="log_logging_info"}' \

--data-urlencode 'match[]={__name__="log_collector_error_count_total"}' \

--data-urlencode 'match[]={__name__="log_forwarder_pipeline_info"}' \

--data-urlencode 'match[]={__name__="log_forwarder_input_info"}' \

--data-urlencode 'match[]={__name__="log_forwarder_output_info"}' \

--data-urlencode 'match[]={__name__="cluster:log_collected_bytes_total:sum"}' \

--data-urlencode 'match[]={__name__="cluster:log_logged_bytes_total:sum"}' \

--data-urlencode 'match[]={__name__="cluster:kata_monitor_running_shim_count:sum"}' \

--data-urlencode 'match[]={__name__="platform:hypershift_hostedclusters:max"}' \

--data-urlencode 'match[]={__name__="platform:hypershift_nodepools:max"}' \

--data-urlencode 'match[]={__name__="namespace:noobaa_unhealthy_bucket_claims:max"}' \

--data-urlencode 'match[]={__name__="namespace:noobaa_buckets_claims:max"}' \

--data-urlencode 'match[]={__name__="namespace:noobaa_unhealthy_namespace_resources:max"}' \

--data-urlencode 'match[]={__name__="namespace:noobaa_namespace_resources:max"}' \

--data-urlencode 'match[]={__name__="namespace:noobaa_unhealthy_namespace_buckets:max"}' \

--data-urlencode 'match[]={__name__="namespace:noobaa_namespace_buckets:max"}' \

--data-urlencode 'match[]={__name__="namespace:noobaa_accounts:max"}' \

--data-urlencode 'match[]={__name__="namespace:noobaa_usage:max"}' \

--data-urlencode 'match[]={__name__="namespace:noobaa_system_health_status:max"}' \

--data-urlencode 'match[]={__name__="ocs_advanced_feature_usage"}' \

--data-urlencode 'match[]={__name__="os_image_url_override:sum"}' \

--data-urlencode 'match[]={__name__="openshift:openshift_network_operator_ipsec_state:info"}'4.3. Red Hat Lightspeed를 사용하여 클러스터 문제 식별

Red Hat Lightspeed는 Insights Operator가 전송하는 데이터를 반복적으로 분석합니다. 여기에는 Deployment Validation Operator(DVO)의 워크로드 권장 사항이 포함됩니다. OpenShift Dedicated 사용자는 Red Hat Hybrid Cloud Console의 Advisor 서비스에 결과를 표시할 수 있습니다.

4.3.1. OpenShift Dedicated용 Red Hat Lightspeed Advisor 정보

Red Hat Lightspeed 권고 서비스를 사용하여 OpenShift Dedicated 클러스터의 상태를 평가하고 모니터링할 수 있습니다. 개별 클러스터에 대한 관심이 있거나 전체 인프라에 관계없이 서비스 가용성, 내결함성, 성능 또는 보안에 영향을 줄 수 있는 문제에 대한 클러스터 인프라 노출을 인식하는 것이 중요합니다.

클러스터에 DVO(Deployment Validation Operator)가 설치된 경우 권장 사항은 구성이 클러스터 상태 문제로 이어질 수 있는 워크로드도 강조 표시합니다.

Red Hat Lightspeed 분석 결과는 Red Hat Hybrid Cloud Console의 Red Hat Lightspeed 권고 서비스에서 확인할 수 있습니다. Red Hat Hybrid Cloud Console에서는 다음 작업을 수행할 수 있습니다.

- 특정 권장 사항의 영향을 받는 클러스터 및 워크로드를 확인합니다.

- 강력한 필터링 기능을 사용하여 결과를 해당 권장 사항으로 구체화합니다.

- 개별 권장 사항, 존재하는 위험에 대한 세부 정보, 개별 클러스터에 맞게 조정된 해결 방법에 대해 자세히 알아보십시오.

- 다른 이해 관계자와 결과를 공유하십시오.

4.3.2. Red Hat Lightspeed 권고 사항 이해

Red Hat Lightspeed 어드바이저 서비스는 클러스터 및 워크로드의 서비스 가용성, 내결함성, 성능 또는 보안에 부정적인 영향을 미칠 수 있는 다양한 클러스터 상태 및 구성 요소 구성에 대한 정보를 제공합니다. 이러한 정보 세트를 Red Hat Lightspeed 권고 서비스의 권장 사항이라고 합니다. 클러스터의 권장 사항에는 다음 정보가 포함됩니다.

- 이름: 권장 사항에 대한 간결한 설명

- 추가 사항: Red Hat Lightspeed 서비스 아카이브에 권장 사항이 게시되었을 때

- 카테고리: 문제가 서비스 가용성, 내결함성, 성능 또는 보안에 부정적인 영향을 미칠 수 있는지 여부

- 총 위험: 조건이 클러스터 또는 워크로드에 부정적인 영향을 미칠 가능성 에서 파생된 값 및 이러한 상황이 발생할 경우 운영에 미치는 영향

- 클러스터: 권장 사항이 감지되는 클러스터 목록

- 설명: 클러스터에 미치는 영향을 포함하여 문제에 대한 간략한 개요

4.3.3. 클러스터와 관련된 잠재적인 문제 표시

이 섹션에서는 OpenShift Cluster Manager 의 Red Hat Lightspeed Advisor 에 Red Hat Lightspeed 보고서를 표시하는 방법을 설명합니다.

Red Hat Lightspeed는 클러스터를 반복적으로 분석하고 최신 결과를 보여줍니다. 예를 들어 문제를 해결하거나 새로운 문제가 발견된 경우 이러한 결과가 변경될 수 있습니다.

사전 요구 사항

- 클러스터는 OpenShift Cluster Manager 에 등록되어 있습니다.

- 원격 상태 보고가 활성화되어 있습니다 (기본값).

- OpenShift Cluster Manager 에 로그인되어 있습니다.

프로세스

OpenShift Cluster Manager 에서 Advisor → Recommendations 로 이동합니다.

결과에 따라 Red Hat Lightspeed 권고 서비스에 다음 중 하나가 표시됩니다.

- Red Hat Lightspeed가 문제를 식별하지 못한 경우 일치하는 권장 사항을 찾을 수 없습니다.

- 위험(낮음, 중간, 중요 및 심각)으로 그룹화된 Red Hat Lightspeed가 감지한 문제 목록입니다.

- Red Hat Lightspeed가 아직 클러스터를 분석하지 않은 경우 아직 클러스터가 없습니다. 클러스터가 설치, 등록 및 인터넷에 연결된 직후 분석이 시작됩니다.

문제가 표시되면 항목 앞의 > 아이콘을 클릭하여 자세한 내용을 확인합니다.

문제에 따라 세부 정보에는 문제에 대한 Red Hat의 자세한 정보 링크가 포함될 수 있습니다.

4.3.4. 모든 Red Hat Lightspeed 조언 서비스 권장 사항 표시

기본적으로 권장 사항 보기는 클러스터에서 탐지된 권장 사항만 표시합니다. 그러나 advisor 서비스의 아카이브에 있는 모든 권장 사항을 볼 수 있습니다.

사전 요구 사항

- 원격 상태 보고가 활성화되어 있습니다 (기본값).

- 클러스터는 Red Hat Hybrid Cloud Console에 등록되어 있습니다.

- OpenShift Cluster Manager 에 로그인되어 있습니다.

프로세스

- OpenShift Cluster Manager 에서 Advisor → Recommendations 로 이동합니다.

영향을 받는 클러스터 및 상태 필터 옆에 있는 X 아이콘을 클릭합니다.

이제 클러스터에 대한 모든 잠재적인 권장 사항을 확인할 수 있습니다.

4.3.5. Advisor 권장 필터

Red Hat Lightspeed 어드바이저 서비스는 많은 권장 사항을 반환할 수 있습니다. 가장 중요한 권장 사항에 중점을 두려면 Advisor 권장 사항 목록에 필터를 적용하여 우선순위가 낮은 권장 사항을 제거할 수 있습니다.

기본적으로 필터는 하나 이상의 클러스터에 영향을 미치는 활성화된 권장 사항만 표시하도록 설정됩니다. Red Hat Lightspeed 라이브러리의 모든 권장 사항 또는 비활성화된 권장 사항을 보려면 필터를 사용자 지정할 수 있습니다.

필터를 적용하려면 필터 유형을 선택한 다음 드롭다운 목록에서 사용할 수 있는 옵션을 기반으로 값을 설정합니다. 권장 사항 목록에 여러 필터를 적용할 수 있습니다.

다음 필터 유형을 설정할 수 있습니다.

- name: 이름으로 권장 사항을 검색합니다.

- 총 위험: 심각,중요,보통 및 낮음에서 하나 이상의 값을 선택하여 클러스터에 미치는 부정적인 영향을 미치는 가능성과 심각도를 나타냅니다.

- 영향: 클러스터 작업의 연속성에 미치는 영향을 나타내는 심각,높음,중간 및 낮음 에서 하나 이상의 값을 선택합니다.

- 가능성: 심각,높음,중간, 낮음 에서 하나 이상의 값을 선택하여 클러스터에 부정적인 영향을 미칠 가능성이 있는지 여부를 나타냅니다.

- 범주: Service Availability,Performance,Fault Tolerance,Security, Best Practice 에서 하나 이상의 카테고리를 선택하여 집중할 수 있습니다.

- 상태: 활성화된 권장 사항(기본값), 비활성화된 권장 사항 또는 모든 권장 사항을 표시하려면 라디오 버튼을 클릭합니다.

- 영향을 받는 클러스터: 현재 하나 이상의 클러스터, 영향을 받지 않는 권장 사항 또는 모든 권장 사항에 영향을 미치는 권장 사항을 표시하도록 필터를 설정합니다.

- 변경 위험: High,Moderate,Low y low 에서 하나 이상의 값을 선택하여 해상도 구현이 클러스터 작업에 미칠 수 있는 위험을 나타냅니다.

4.3.5.1. Red Hat Lightspeed 권고 사항 필터링 권장 사항

OpenShift Dedicated 클러스터 관리자는 권장 사항 목록에 표시되는 권장 사항을 필터링할 수 있습니다. 필터를 적용하면 보고된 권장 사항 수를 줄이고 가장 높은 우선 순위 권장 사항에 집중할 수 있습니다.

다음 절차에서는 카테고리 필터를 설정하고 제거하는 방법을 보여줍니다. 그러나 절차는 모든 필터 유형과 각 값에 적용할 수 있습니다.

사전 요구 사항

하이브리드 클라우드 콘솔의 OpenShift Cluster Manager 에 로그인되어 있습니다.

프로세스

- OpenShift > Advisor > Recommendations로 이동합니다.

- 기본 필터 유형 드롭다운 목록에서 카테고리 필터 유형을 선택합니다.

- filter-value 드롭다운 목록을 펼치고 보려는 각 범주의 권장 사항 옆에 있는 확인란을 선택합니다. 불필요한 카테고리에 대해 확인란을 지웁니다.

- 선택 사항: 목록을 추가로 구체화하려면 필터를 추가합니다.

선택한 범주의 권장 사항만 목록에 표시됩니다.

검증

- 필터를 적용한 후 업데이트된 권장 사항 목록을 볼 수 있습니다. 적용된 필터는 기본 필터 옆에 추가됩니다.

4.3.5.2. Red Hat Lightspeed 서비스 권장 사항에서 필터 제거

권장 사항 목록에 여러 필터를 적용할 수 있습니다. 준비가 되면 개별적으로 제거하거나 완전히 재설정할 수 있습니다.

개별적으로 필터 제거

- 기본 필터를 포함하여 각 필터 옆에 있는 X 아이콘을 클릭하여 개별적으로 제거합니다.

기본이 아닌 모든 필터 제거

- 새로 고침 필터 를 클릭하여 적용한 필터만 제거하고 기본 필터를 그대로 둡니다.

4.3.6. Red Hat Lightspeed 권고 사항 비활성화 권장 사항

보고서에 더 이상 표시되지 않도록 클러스터에 영향을 미치는 특정 권장 사항을 비활성화할 수 있습니다. 단일 클러스터 또는 모든 클러스터에 대한 권장 사항을 비활성화할 수 있습니다.

모든 클러스터에 대한 권장 사항을 비활성화하는 것은 향후 클러스터에도 적용됩니다.

사전 요구 사항

- 원격 상태 보고가 활성화되어 있습니다 (기본값).

- 클러스터는 OpenShift Cluster Manager 에 등록되어 있습니다.

- OpenShift Cluster Manager 에 로그인되어 있습니다.

프로세스

- OpenShift Cluster Manager 에서 Advisor → Recommendations 로 이동합니다.

- 선택 사항: 필요에 따라 클러스터에 영향을 미치는 상태 필터를 사용합니다.

다음 방법 중 하나를 사용하여 경고를 비활성화합니다.

경고를 비활성화하려면 다음을 수행합니다.

-

해당 경고에 대한 옵션 메뉴

를 클릭한 다음 권장 사항 비활성화 를 클릭합니다.

를 클릭한 다음 권장 사항 비활성화 를 클릭합니다.

- 확인 참고 사항을 입력하고 저장을 클릭합니다.

-

해당 경고에 대한 옵션 메뉴

경고를 비활성화하기 전에 이 경고의 영향을 받는 클러스터를 보려면 다음을 수행합니다.

- 비활성화할 권장 사항 이름을 클릭합니다. 단일 권장 사항 페이지로 이동합니다.

- 영향을 받는 클러스터 섹션의 클러스터 목록을 검토합니다.

- 동작 → 권장 사항 비활성화 를 클릭하여 모든 클러스터에 대한 경고를 비활성화합니다.

- 확인 참고 사항을 입력하고 저장을 클릭합니다.

4.3.7. 이전에 비활성화된 Red Hat Lightspeed 서비스 권장 사항 활성화

모든 클러스터에 대해 권장 사항이 비활성화되면 Red Hat Lightspeed 권고 서비스에 더 이상 권장 사항이 표시되지 않습니다. 이 동작을 변경할 수 있습니다.

사전 요구 사항

- 원격 상태 보고가 활성화되어 있습니다 (기본값).

- 클러스터는 OpenShift Cluster Manager 에 등록되어 있습니다.

- OpenShift Cluster Manager 에 로그인되어 있습니다.

프로세스

- OpenShift Cluster Manager 에서 Advisor → Recommendations 로 이동합니다.

비활성화된 권장 사항에 표시할 권장 사항을 필터링합니다.

- Status 드롭다운 메뉴에서 Status 를 선택합니다.

- Filter by status 드롭다운 메뉴에서 Disabled 를 선택합니다.

- 선택 사항: 영향을 받는 클러스터 필터를 지웁니다.

- 활성화할 권장 사항을 찾습니다.

-

옵션 메뉴

를 클릭한 다음 권장 사항 사용을 클릭합니다.

를 클릭한 다음 권장 사항 사용을 클릭합니다.

4.3.8. 워크로드에 대한 Red Hat Lightspeed 조언 서비스 권장 사항 정보

Red Hat Lightspeed 권고 서비스를 사용하여 클러스터뿐만 아니라 워크로드에 영향을 미치는 권장 사항에 대한 정보를 보고 관리할 수 있습니다. 권고 서비스는 배포 검증을 활용하고 OpenShift 클러스터 관리자가 배포 정책의 모든 런타임 위반을 확인할 수 있도록 지원합니다. OpenShift > Advisor > Red Hat Hybrid Cloud Console에서 워크로드에 대한 권장 사항을 확인할 수 있습니다. 자세한 내용은 다음 추가 리소스를 참조하십시오.

4.3.9. 웹 콘솔에서 Red Hat Lightspeed 상태 표시

Red Hat Lightspeed는 클러스터를 반복적으로 분석하고 OpenShift Dedicated 웹 콘솔에서 확인된 잠재적 클러스터 문제의 상태를 표시할 수 있습니다. 이 상태에는 다양한 카테고리의 문제 수가 표시되고 자세한 내용은 OpenShift Cluster Manager 의 보고서에 대한 링크입니다.

사전 요구 사항

- 클러스터는 OpenShift Cluster Manager 에 등록되어 있습니다.

- 원격 상태 보고가 활성화되어 있습니다 (기본값).

- OpenShift Dedicated 웹 콘솔에 로그인되어 있습니다.

프로세스

- OpenShift Dedicated 웹 콘솔에서 홈 → 개요 로 이동합니다.

상태 카드에서 Red Hat Lightspeed 를 클릭합니다.

팝업 창에 잠재적인 문제가 위험으로 그룹화되어 나열됩니다. 개별 카테고리를 클릭하거나 Red Hat Lightspeed Advisor의 모든 권장 사항 보기를 클릭하여 자세한 내용을 표시합니다.

4.4. Insights Operator 사용

Insights Operator는 구성 및 구성 요소 오류 상태를 주기적으로 수집하고 기본적으로 2시간마다 데이터를 Red Hat에 보고합니다. Red Hat은 이러한 정보를 통해 구성 및 Telemetry를 통해 보고된 것보다 더 깊은 오류 데이터를 평가할 수 있습니다. OpenShift Dedicated 사용자는 Red Hat Hybrid Cloud Console의 Advisor 서비스에 보고서를 표시할 수 있습니다.

4.4.1. Insights Operator 경고 이해

Insights Operator는 Prometheus 모니터링 시스템을 통해 Alertmanager에 경고를 선언합니다. 다음 방법 중 하나를 사용하여 OpenShift Dedicated 웹 콘솔의 경고 UI에서 이러한 경고를 볼 수 있습니다.

- 관리자 화면에서 모니터링 → 경고를 클릭합니다.

- 개발자 화면에서 모니터링 → <project_name> → 경고 탭을 클릭합니다.

현재 조건이 충족되면 Insights Operator에서 다음 경고를 보냅니다.

| 경고 | 설명 |

|---|---|

|

| Insights Operator가 비활성화되어 있습니다. |

|

| Red Hat 서브스크립션 관리에서는 간단한 컨텐츠 액세스가 허용되지 않습니다. |

|

| Red Hat Lightspeed에는 클러스터에 대한 적극적인 권장 사항이 있습니다. |

4.4.2. Deployment Validation Operator 데이터 난독 처리

기본적으로 DVO(배포 유효성 검사 Operator)를 설치하면 리소스의 이름 및 고유 식별자(UID)가 OpenShift Dedicated용 Insights Operator에서 캡처 및 처리하는 데이터에 포함됩니다. 클러스터 관리자인 경우 DVO(Deployment Validation Operator)의 데이터를 난독화하도록 Insights Operator를 구성할 수 있습니다. 예를 들어, Red Hat으로 전송되는 아카이브 파일에서 워크로드 이름을 난독화할 수 있습니다.

리소스 이름을 난독화하려면 다음 절차에 설명된 대로 insights-config ConfigMap 오브젝트 의 난독화 속성을 수동으로 설정해야 합니다.

사전 요구 사항

- 원격 상태 보고가 활성화되어 있습니다 (기본값).

- "cluster-admin" 역할을 사용하여 OpenShift Dedicated 웹 콘솔에 로그인되어 있습니다.

-

insights-config

ConfigMap오브젝트는openshift-insights네임스페이스에 있습니다. - 클러스터가 자체 관리되고 Deployment Validation Operator가 설치됩니다.

프로세스

- 워크로드 → ConfigMaps 로 이동하여 Project: openshift-insights 를 선택합니다.

-

insights-configConfigMap오브젝트를 클릭하여 엽니다. - 작업을 클릭하고 ConfigMap 편집을 선택합니다.

- YAML 보기 라디오 버튼을 클릭합니다.

파일에서

workload_names값을 사용하여난독 처리속성을 설정합니다.apiVersion: v1 kind: ConfigMap # ... data: config.yaml: | dataReporting: obfuscation: - workload_names # ...- 저장을 클릭합니다. insights-config config-map 세부 정보 페이지가 열립니다.

-

config.yaml난독 처리속성 값이- workload_names로 설정되어 있는지 확인합니다.

5장. 클러스터에 대한 데이터 수집

지원 사례를 여는 경우 클러스터에 대한 디버깅 정보를 Red Hat 지원에 제공하면 도움이 됩니다.

다음을 제공하는 것이 좋습니다.

5.1. must-gather 툴 정보

oc adm must-gather CLI 명령은 다음을 포함하여 문제를 디버깅하는 데 필요할 가능성이 높은 클러스터에서 정보를 수집합니다.

- 리소스 정의

- 서비스 로그

기본적으로 oc adm must-gather 명령은 기본 플러그인 이미지를 사용하고 ./must-gather.local 에 씁니다.

또는 다음 섹션에 설명된 대로 적절한 인수로 명령을 실행하여 특정 정보를 수집할 수 있습니다.

하나 이상의 특정 기능과 관련된 데이터를 수집하려면 다음 섹션에 나열된 대로 이미지와 함께

--image인수를 사용합니다.예를 들면 다음과 같습니다.

$ oc adm must-gather \ --image=registry.redhat.io/container-native-virtualization/cnv-must-gather-rhel9:v4.20.1감사 로그를 수집하려면 다음 섹션에 설명된 대로

-- /usr/bin/gather_audit_logs인수를 사용하십시오.예를 들면 다음과 같습니다.

$ oc adm must-gather -- /usr/bin/gather_audit_logs참고- 감사 로그는 파일 크기를 줄이기 위해 기본 정보 세트의 일부로 수집되지 않습니다.

-

Windows 운영 체제에서

cwRsync클라이언트를 설치하고oc rsync명령과 함께 사용할PATH변수에 추가합니다.

oc adm must-gather 를 실행하면 클러스터의 새 프로젝트에 임의의 이름이 있는 새 Pod가 생성됩니다. 해당 Pod에서 데이터가 수집되어 현재 작업 디렉터리에 must-gather.local 로 시작하는 새 디렉터리에 저장됩니다.

예를 들면 다음과 같습니다.

NAMESPACE NAME READY STATUS RESTARTS AGE

...

openshift-must-gather-5drcj must-gather-bklx4 2/2 Running 0 72s

openshift-must-gather-5drcj must-gather-s8sdh 2/2 Running 0 72s

...

필요한 경우 --run-namespace 옵션을 사용하여 특정 네임스페이스에서 oc adm must-gather 명령을 실행할 수 있습니다.

예를 들면 다음과 같습니다.

$ oc adm must-gather --run-namespace <namespace> \

--image=registry.redhat.io/container-native-virtualization/cnv-must-gather-rhel9:v4.20.15.1.1. Red Hat 지원을 위한 클러스터에 대한 데이터 수집

oc adm must-gather CLI 명령을 사용하여 클러스터에 대한 디버깅 정보를 수집할 수 있습니다.

사전 요구 사항

cluster-admin역할의 사용자로 클러스터에 액세스할 수 있어야 합니다.참고OpenShift Dedicated 배포에서 CCO(Customer Cloud Subscription) 모델을 사용하지 않는 고객은

oc adm must-gather명령을 사용할 수 없습니다.cluster-admin권한이 필요합니다.-

OpenShift CLI(

oc)가 설치되어 있어야 합니다.

프로세스

-

must-gather데이터를 저장하려는 디렉터리로 이동합니다. oc adm must-gather명령을 실행합니다.$ oc adm must-gather참고이 명령은 기본적으로 임의의 컨트롤 플레인 노드를 선택하므로 Pod가

NotReady및SchedulingDisabled상태인 컨트롤 플레인 노드로 예약할 수 있습니다.예를 들어 클러스터에서 Pod를 예약할 수 없는 경우와 같이 명령이 실패하면

oc adm inspect명령을 사용하여 특정 리소스에 대한 정보를 수집합니다.참고권장되는 리소스를 얻으려면 Red Hat 지원에 문의하십시오.

작업 디렉토리에서 생성된

must-gather디렉토리에서 압축 파일을 만듭니다. 고유한 must-gather 데이터에 대한 날짜 및 클러스터 ID를 제공해야 합니다. 클러스터 ID를 찾는 방법에 대한 자세한 내용은 OpenShift 클러스터에서 클러스터 ID 또는 이름을 찾는 방법을 참조하십시오. 예를 들어 Linux 운영 체제를 사용하는 컴퓨터에서 다음 명령을 실행합니다.$ tar cvaf must-gather-`date +"%m-%d-%Y-%H-%M-%S"`-<cluster_id>.tar.gz <must_gather_local_dir>1 - 1

- &

lt;must_gather_local_dir>을 실제 디렉터리 이름으로 바꿉니다.

- 압축 파일을 Red Hat 고객 포털 의 고객 지원 페이지의 지원 케이스에 첨부합니다.

5.1.2. must-gather 플래그

다음 표에 나열된 플래그는 oc adm must-gather 명령과 함께 사용할 수 있습니다.

| 플래그 | 명령 예 | 설명 |

|---|---|---|

|

|

|

|

|

|

| 수집된 데이터가 기록된 로컬 시스템에서 특정 디렉터리를 설정합니다. |

|

|

|

|

|

|

|

실행할 |

|

|

|

실행할 |

|

|

| 사용할 특정 노드를 설정합니다. 지정하지 않으면 기본적으로 임의의 마스터가 사용됩니다. |

|

|

| 사용할 특정 노드 선택기를 설정합니다. 클러스터 노드 집합의 데이터를 동시에 캡처해야 하는 명령과 이미지를 지정할 때만 관련이 있습니다. |

|

|

|

|

|

|

|

지정된 기간보다 최신 로그만 반환합니다. 기본값은 모든 로그입니다. 플러그인을 사용하는 것이 좋지만 이를 지원할 필요는 없습니다. |

|

|

|

(RFC3339) 형식으로 표시된 특정 날짜와 시간 후에만 로그를 반환합니다. 기본값은 모든 로그입니다. 플러그인을 사용하는 것이 좋지만 이를 지원할 필요는 없습니다. |

|

|

| 수집된 데이터를 복사하는 Pod에 특정 디렉터리를 설정합니다. |

|

|

| 시간 초과 전 데이터를 수집하는 시간(초, 분 또는 시간, 3s, 5m 또는 2h)입니다. 지정된 시간은 0보다 커야 합니다. 지정하지 않는 경우 기본값은 10분입니다. |

|

|

|

|

5.1.3. 특정 기능에 대한 데이터 수집

oc adm must-gather CLI 명령을 --image 또는 --image-stream 인수와 함께 사용하여 특정 기능에 대한 디버깅 정보를 수집할 수 있습니다. must-gather 툴은 여러 이미지를 지원하므로 단일 명령을 실행하여 둘 이상의 기능에 대한 데이터를 수집할 수 있습니다.

| 이미지 | 목적 |

|---|---|

|

| OpenShift Virtualization의 데이터 수집. |

|

| OpenShift Serverless의 데이터 수집. |

|

| Red Hat OpenShift Service Mesh의 데이터 수집 |

|

| 호스팅된 컨트롤 플레인의 데이터 수집 |

|

| Migration Toolkit for Containers의 데이터 수집 |

|

| 로깅을 위한 데이터 수집 |

|

| Network Observability Operator의 데이터 수집 |

|

| Red Hat OpenShift GitOps의 데이터 수집 |

|

| Secrets Store CSI Driver Operator의 데이터 수집 |

OpenShift Dedicated 구성 요소의 최신 버전을 확인하려면 Red Hat Customer Portal의 OpenShift Operator 라이프 사이클 웹 페이지를 참조하십시오.

사전 요구 사항

-

cluster-admin역할의 사용자로 클러스터에 액세스할 수 있어야 합니다. -

OpenShift CLI(

oc)가 설치되어 있어야 합니다.

프로세스

-

must-gather데이터를 저장하려는 디렉터리로 이동합니다. --image또는--image-stream인수를 하나 이상 사용하여oc adm must-gather명령을 실행합니다.참고-

특정 기능 데이터 외에도 기본

must-gather데이터를 수집하려면--image-stream=openshift/must-gather인수를 추가하십시오.

예를 들어 다음 명령은 기본 클러스터 데이터와 OpenShift Virtualization 관련 정보를 모두 수집합니다.

$ oc adm must-gather \ --image-stream=openshift/must-gather \1 --image=registry.redhat.io/container-native-virtualization/cnv-must-gather-rhel9:v4.20.12 must-gather툴을 추가 인수와 함께 사용하여 클러스터의 OpenShift 로깅 및 Cluster Logging Operator와 관련된 데이터를 수집할 수 있습니다. OpenShift 로깅의 경우 다음 명령을 실행합니다.$ oc adm must-gather --image=$(oc -n openshift-logging get deployment.apps/cluster-logging-operator \ -o jsonpath='{.spec.template.spec.containers[?(@.name == "cluster-logging-operator")].image}')예 5.1. OpenShift 로깅의

must-gather출력 예├── cluster-logging │ ├── clo │ │ ├── cluster-logging-operator-74dd5994f-6ttgt │ │ ├── clusterlogforwarder_cr │ │ ├── cr │ │ ├── csv │ │ ├── deployment │ │ └── logforwarding_cr │ ├── collector │ │ ├── fluentd-2tr64 │ ├── curator │ │ └── curator-1596028500-zkz4s │ ├── eo │ │ ├── csv │ │ ├── deployment │ │ └── elasticsearch-operator-7dc7d97b9d-jb4r4 │ ├── es │ │ ├── cluster-elasticsearch │ │ │ ├── aliases │ │ │ ├── health │ │ │ ├── indices │ │ │ ├── latest_documents.json │ │ │ ├── nodes │ │ │ ├── nodes_stats.json │ │ │ └── thread_pool │ │ ├── cr │ │ ├── elasticsearch-cdm-lp8l38m0-1-794d6dd989-4jxms │ │ └── logs │ │ ├── elasticsearch-cdm-lp8l38m0-1-794d6dd989-4jxms │ ├── install │ │ ├── co_logs │ │ ├── install_plan │ │ ├── olmo_logs │ │ └── subscription │ └── kibana │ ├── cr │ ├── kibana-9d69668d4-2rkvz ├── cluster-scoped-resources │ └── core │ ├── nodes │ │ ├── ip-10-0-146-180.eu-west-1.compute.internal.yaml │ └── persistentvolumes │ ├── pvc-0a8d65d9-54aa-4c44-9ecc-33d9381e41c1.yaml ├── event-filter.html ├── gather-debug.log └── namespaces ├── openshift-logging │ ├── apps │ │ ├── daemonsets.yaml │ │ ├── deployments.yaml │ │ ├── replicasets.yaml │ │ └── statefulsets.yaml │ ├── batch │ │ ├── cronjobs.yaml │ │ └── jobs.yaml │ ├── core │ │ ├── configmaps.yaml │ │ ├── endpoints.yaml │ │ ├── events │ │ │ ├── curator-1596021300-wn2ks.162634ebf0055a94.yaml │ │ │ ├── curator.162638330681bee2.yaml │ │ │ ├── elasticsearch-delete-app-1596020400-gm6nl.1626341a296c16a1.yaml │ │ │ ├── elasticsearch-delete-audit-1596020400-9l9n4.1626341a2af81bbd.yaml │ │ │ ├── elasticsearch-delete-infra-1596020400-v98tk.1626341a2d821069.yaml │ │ │ ├── elasticsearch-rollover-app-1596020400-cc5vc.1626341a3019b238.yaml │ │ │ ├── elasticsearch-rollover-audit-1596020400-s8d5s.1626341a31f7b315.yaml │ │ │ ├── elasticsearch-rollover-infra-1596020400-7mgv8.1626341a35ea59ed.yaml │ │ ├── events.yaml │ │ ├── persistentvolumeclaims.yaml │ │ ├── pods.yaml │ │ ├── replicationcontrollers.yaml │ │ ├── secrets.yaml │ │ └── services.yaml │ ├── openshift-logging.yaml │ ├── pods │ │ ├── cluster-logging-operator-74dd5994f-6ttgt │ │ │ ├── cluster-logging-operator │ │ │ │ └── cluster-logging-operator │ │ │ │ └── logs │ │ │ │ ├── current.log │ │ │ │ ├── previous.insecure.log │ │ │ │ └── previous.log │ │ │ └── cluster-logging-operator-74dd5994f-6ttgt.yaml │ │ ├── cluster-logging-operator-registry-6df49d7d4-mxxff │ │ │ ├── cluster-logging-operator-registry │ │ │ │ └── cluster-logging-operator-registry │ │ │ │ └── logs │ │ │ │ ├── current.log │ │ │ │ ├── previous.insecure.log │ │ │ │ └── previous.log │ │ │ ├── cluster-logging-operator-registry-6df49d7d4-mxxff.yaml │ │ │ └── mutate-csv-and-generate-sqlite-db │ │ │ └── mutate-csv-and-generate-sqlite-db │ │ │ └── logs │ │ │ ├── current.log │ │ │ ├── previous.insecure.log │ │ │ └── previous.log │ │ ├── curator-1596028500-zkz4s │ │ ├── elasticsearch-cdm-lp8l38m0-1-794d6dd989-4jxms │ │ ├── elasticsearch-delete-app-1596030300-bpgcx │ │ │ ├── elasticsearch-delete-app-1596030300-bpgcx.yaml │ │ │ └── indexmanagement │ │ │ └── indexmanagement │ │ │ └── logs │ │ │ ├── current.log │ │ │ ├── previous.insecure.log │ │ │ └── previous.log │ │ ├── fluentd-2tr64 │ │ │ ├── fluentd │ │ │ │ └── fluentd │ │ │ │ └── logs │ │ │ │ ├── current.log │ │ │ │ ├── previous.insecure.log │ │ │ │ └── previous.log │ │ │ ├── fluentd-2tr64.yaml │ │ │ └── fluentd-init │ │ │ └── fluentd-init │ │ │ └── logs │ │ │ ├── current.log │ │ │ ├── previous.insecure.log │ │ │ └── previous.log │ │ ├── kibana-9d69668d4-2rkvz │ │ │ ├── kibana │ │ │ │ └── kibana │ │ │ │ └── logs │ │ │ │ ├── current.log │ │ │ │ ├── previous.insecure.log │ │ │ │ └── previous.log │ │ │ ├── kibana-9d69668d4-2rkvz.yaml │ │ │ └── kibana-proxy │ │ │ └── kibana-proxy │ │ │ └── logs │ │ │ ├── current.log │ │ │ ├── previous.insecure.log │ │ │ └── previous.log │ └── route.openshift.io │ └── routes.yaml └── openshift-operators-redhat ├── ...-

특정 기능 데이터 외에도 기본

--image또는--image-stream인수를 하나 이상 사용하여oc adm must-gather명령을 실행합니다. 예를 들어 다음 명령은 기본 클러스터 데이터와 KubeVirt 관련 정보를 모두 수집합니다.$ oc adm must-gather \ --image-stream=openshift/must-gather \1 --image=quay.io/kubevirt/must-gather2 작업 디렉토리에서 생성된

must-gather디렉토리에서 압축 파일을 만듭니다. 고유한 must-gather 데이터에 대한 날짜 및 클러스터 ID를 제공해야 합니다. 클러스터 ID를 찾는 방법에 대한 자세한 내용은 OpenShift 클러스터에서 클러스터 ID 또는 이름을 찾는 방법을 참조하십시오. 예를 들어 Linux 운영 체제를 사용하는 컴퓨터에서 다음 명령을 실행합니다.$ tar cvaf must-gather-`date +"%m-%d-%Y-%H-%M-%S"`-<cluster_id>.tar.gz <must_gather_local_dir>1 - 1

- &

lt;must_gather_local_dir>을 실제 디렉터리 이름으로 바꿉니다.

- 압축 파일을 Red Hat 고객 포털 의 고객 지원 페이지의 지원 케이스에 첨부합니다.

5.1.4. 네트워크 로그 수집

클러스터의 모든 노드에서 네트워크 로그를 수집할 수 있습니다.

프로세스

-- gather_network_logs를 사용하여oc adm must-gather명령을 실행합니다.$ oc adm must-gather -- gather_network_logs참고기본적으로

must-gather툴은 클러스터의 모든 노드에서 OVNnbdb및sbdb데이터베이스를 수집합니다. OVNnbdb데이터베이스에 대한 OVN-Kubernetes 트랜잭션이 포함된 추가 로그를 포함하도록-- gather_network_logs옵션을 추가합니다.작업 디렉토리에서 생성된

must-gather디렉토리에서 압축 파일을 만듭니다. 고유한 must-gather 데이터에 대한 날짜 및 클러스터 ID를 제공해야 합니다. 클러스터 ID를 찾는 방법에 대한 자세한 내용은 OpenShift 클러스터에서 클러스터 ID 또는 이름을 찾는 방법을 참조하십시오. 예를 들어 Linux 운영 체제를 사용하는 컴퓨터에서 다음 명령을 실행합니다.$ tar cvaf must-gather-`date +"%m-%d-%Y-%H-%M-%S"`-<cluster_id>.tar.gz <must_gather_local_dir>1 - 1

- &

lt;must_gather_local_dir>을 실제 디렉터리 이름으로 바꿉니다.

- 압축 파일을 Red Hat 고객 포털 의 고객 지원 페이지의 지원 케이스에 첨부합니다.

5.1.5. must-gather 스토리지 제한 변경

oc adm must-gather 명령을 사용하여 데이터를 수집할 때 정보의 기본 최대 스토리지는 컨테이너의 스토리지 용량의 30%입니다. 30% 제한에 도달하면 컨테이너가 종료되고 수집 프로세스가 중지됩니다. 이미 수집된 정보는 로컬 스토리지에 다운로드되어 있습니다. must-gather 명령을 다시 실행하려면 스토리지 용량이 더 많은 컨테이너를 사용하거나 최대 볼륨 백분율을 조정해야 합니다.

컨테이너가 스토리지 제한에 도달하면 다음 예와 유사한 오류 메시지가 생성됩니다.

출력 예

Disk usage exceeds the volume percentage of 30% for mounted directory. Exiting...사전 요구 사항

-

cluster-admin역할의 사용자로 클러스터에 액세스할 수 있어야 합니다. -

OpenShift CLI(

oc)가 설치되어 있어야 합니다.

프로세스

volume-percentage플래그를 사용하여oc adm must-gather명령을 실행합니다. 새 값은 100을 초과할 수 없습니다.$ oc adm must-gather --volume-percentage <storage_percentage>

5.2. 지원 로그 수집 정보

Log Gather Operator는 디버깅 데이터 수집을 자동화하기 위해 기존 must-gather 툴의 기능을 기반으로 합니다. 수집된 정보를 단일 .tar 파일에 패키징하고 지정된 Red Hat 지원 케이스에 자동으로 업로드하여 문제 해결을 간소화합니다.

지원 로그 수집은 기술 프리뷰 기능 전용입니다. 기술 프리뷰 기능은 Red Hat 프로덕션 서비스 수준 계약(SLA)에서 지원되지 않으며 기능적으로 완전하지 않을 수 있습니다. 따라서 프로덕션 환경에서 사용하는 것은 권장하지 않습니다. 이러한 기능을 사용하면 향후 제품 기능을 조기에 이용할 수 있어 개발 과정에서 고객이 기능을 테스트하고 피드백을 제공할 수 있습니다.

Red Hat 기술 프리뷰 기능의 지원 범위에 대한 자세한 내용은 다음 링크를 참조하십시오.

지원 로그 수집의 주요 기능은 다음과 같습니다.

- 관리자 권한이 필요 없음: 승격된 권한 없이도 로그를 수집하고 업로드할 수 있으므로 관리자가 아닌 사용자가 데이터를 안전하게 수집할 수 있습니다.

- 간소화된 로그 수집: 리소스 정의 및 서비스 로그와 같은 클러스터에서 디버깅 데이터를 수집합니다.

-

구성 가능한 데이터 업로드:

.tar파일을 지원 케이스에 자동으로 업로드하거나 수동 업로드를 위해 로컬로 저장할 수 있는 구성 옵션을 제공합니다.

5.2.1. 웹 콘솔을 사용하여 지원 로그 수집 설치

웹 콘솔을 사용하여 Support Log Gather를 설치할 수 있습니다.

지원 로그 수집은 기술 프리뷰 기능 전용입니다. 기술 프리뷰 기능은 Red Hat 프로덕션 서비스 수준 계약(SLA)에서 지원되지 않으며 기능적으로 완전하지 않을 수 있습니다. 따라서 프로덕션 환경에서 사용하는 것은 권장하지 않습니다. 이러한 기능을 사용하면 향후 제품 기능을 조기에 이용할 수 있어 개발 과정에서 고객이 기능을 테스트하고 피드백을 제공할 수 있습니다.

Red Hat 기술 프리뷰 기능의 지원 범위에 대한 자세한 내용은 다음 링크를 참조하십시오.

사전 요구 사항

-

cluster-admin권한이 있는 클러스터에 액세스할 수 있습니다. - OpenShift Dedicated 웹 콘솔에 액세스할 수 있습니다.

프로세스

- OpenShift Dedicated 웹 콘솔에 로그인합니다.

- 에코시스템 → 소프트웨어 카탈로그 로 이동합니다.

- 필터 상자에 Support Log Gather 를 입력합니다.

- Support Log Gather 를 선택합니다.

- 버전 목록에서 지원 로그 수집 버전을 선택하고 설치를 클릭합니다.

Operator 설치 페이지에서 설치 설정을 구성합니다.

Operator의 설치된 네임스페이스 를 선택합니다.

기본 Operator 네임스페이스는

must-gather-operator입니다.must-gather-operator네임스페이스가 없는 경우 자동으로 생성됩니다.업데이트 승인 전략을 선택합니다.

- 최신 버전이 사용 가능할 때 OLM(Operator Lifecycle Manager)에서 Operator를 자동으로 업데이트하려면 Automatic 을 선택합니다.

- 적절한 인증 정보가 있는 사용자가 Operator 업데이트를 승인해야 하는 경우 Manual 을 선택합니다.

- 설치를 클릭합니다.

검증

Operator가 성공적으로 설치되었는지 확인합니다.

- 에코시스템 → 소프트웨어 카탈로그 로 이동합니다.

-

must-gather-operator네임스페이스에 상태 Succeeded 로 지원 로그 가 나열되어 있는지 확인합니다.

지원 로그 수집 Pod가 실행 중인지 확인합니다.

- 워크로드 → Pod로 이동합니다.

Support Log Gather Pod의 상태가 Running 인지 확인합니다.

Pod가 가동되어 실행된 후에만 지원 로그 Gather를 사용할 수 있습니다.

5.2.2. CLI를 사용하여 지원 로그 수집 설치

지원 케이스에 대한 자동화된 로그 수집을 활성화하려면 CLI(명령줄 인터페이스)에서 Support Log Gather를 설치할 수 있습니다.

지원 로그 수집은 기술 프리뷰 기능 전용입니다. 기술 프리뷰 기능은 Red Hat 프로덕션 서비스 수준 계약(SLA)에서 지원되지 않으며 기능적으로 완전하지 않을 수 있습니다. 따라서 프로덕션 환경에서 사용하는 것은 권장하지 않습니다. 이러한 기능을 사용하면 향후 제품 기능을 조기에 이용할 수 있어 개발 과정에서 고객이 기능을 테스트하고 피드백을 제공할 수 있습니다.

Red Hat 기술 프리뷰 기능의 지원 범위에 대한 자세한 내용은 다음 링크를 참조하십시오.

사전 요구 사항

-

cluster-admin권한이 있는 클러스터에 액세스할 수 있습니다.

프로세스

다음 명령을 실행하여

must-gather-operator라는 새 프로젝트를 생성합니다.$ oc new-project must-gather-operatorOperatorGroup오브젝트를 생성합니다.OperatorGroup오브젝트를 정의하는 YAML 파일(예:operatorGroup.yaml)을 생성합니다.apiVersion: operators.coreos.com/v1 kind: OperatorGroup metadata: name: must-gather-operator namespace: must-gather-operator spec: {}다음 명령을 실행하여

OperatorGroup오브젝트를 생성합니다.$ oc create -f operatorGroup.yaml

Subscription오브젝트를 생성합니다.Subscription오브젝트를 정의하는 YAML 파일(예:subscription.yaml)을 생성합니다.apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: support-log-gather-operator namespace: must-gather-operator spec: channel: tech-preview name: support-log-gather-operator source: redhat-operators sourceNamespace: openshift-marketplace installPlanApproval: Automatic다음 명령을 실행하여 서브스크립션 오브젝트를 생성합니다.

$ oc create -f subscription.yaml

검증

다음 명령을 실행하여 Operator 네임스페이스에서 Pod의 상태를 확인합니다.

$ oc get pods출력 예

NAME READY STATUS RESTARTS AGE must-gather-operator-657fc74d64-2gg2w 1/1 Running 0 13m모든 Pod의 상태는

Running이어야 합니다.다음 명령을 실행하여 서브스크립션이 생성되었는지 확인합니다.

$ oc get subscription -n must-gather-operator출력 예

NAME PACKAGE SOURCE CHANNEL support-log-gather-operator support-log-gather-operator redhat-operators tech-preview다음 명령을 실행하여 Operator가 설치되었는지 확인합니다.

$ oc get csv -n must-gather-operator출력 예

NAME DISPLAY VERSION REPLACES PHASE support-log-gather-operator.v4.20.0 support log gather 4.20.0 Succeeded

5.2.3. 지원 로그 수집 인스턴스 구성

클러스터에서 진단 데이터 수집을 자동화하려면 CLI(명령줄 인터페이스)에서 MustGather CR(사용자 정의 리소스)을 생성해야 합니다. 또한 이 프로세스는 Red Hat 지원 케이스에 데이터를 자동으로 업로드합니다.

지원 로그 수집은 기술 프리뷰 기능 전용입니다. 기술 프리뷰 기능은 Red Hat 프로덕션 서비스 수준 계약(SLA)에서 지원되지 않으며 기능적으로 완전하지 않을 수 있습니다. 따라서 프로덕션 환경에서 사용하는 것은 권장하지 않습니다. 이러한 기능을 사용하면 향후 제품 기능을 조기에 이용할 수 있어 개발 과정에서 고객이 기능을 테스트하고 피드백을 제공할 수 있습니다.

Red Hat 기술 프리뷰 기능의 지원 범위에 대한 자세한 내용은 다음 링크를 참조하십시오.

사전 요구 사항

-

OpenShift CLI(

oc) 툴을 설치했습니다. - 클러스터에 Support Log Gather가 설치되어 있습니다.

- Red Hat 지원 케이스 ID가 있습니다.

- Red Hat 고객 포털 인증 정보가 포함된 Kubernetes 시크릿을 생성했습니다. 시크릿에는 사용자 이름 필드와 암호 필드가 포함되어야 합니다.

- 서비스 계정을 생성했습니다.

프로세스

다음 기본 구성이 포함된

support-log-gather.yaml과 같은MustGatherCR의 YAML 파일을 생성합니다.support-log-gather.yaml예apiVersion: operator.openshift.io/v1alpha1 kind: MustGather metadata: name: example-mg namespace: must-gather-operator spec: serviceAccountName: must-gather-operator audit: true proxyConfig: httpProxy: "http://proxy.example.com:8080" httpsProxy: "https://proxy.example.com:8443" noProxy: ".example.com,localhost" mustGatherTimeout: "1h30m9s" uploadTarget: type: SFTP sftp: caseID: "04230315" caseManagementAccountSecretRef: name: mustgather-creds host: "sftp.access.redhat.com" retainResourcesOnCompletion: true storage: type: PersistentVolume persistentVolume: claim: name: mustgather-pvc subPath: must-gather-bundles/case-04230315구성 매개변수에 대한 자세한 내용은 " MustGather 사용자 정의 리소스에 대한 구성 매개변수"를 참조하십시오.

다음 명령을 실행하여

MustGather오브젝트를 생성합니다.$ oc create -f support-log-gather.yaml

검증

다음 명령을 실행하여

MustGatherCR이 생성되었는지 확인합니다.$ oc get mustgather출력 예

NAME AGE example-mg 7s다음 명령을 실행하여 Operator 네임스페이스에서 Pod의 상태를 확인합니다.

$ oc get pods출력 예

NAME READY STATUS RESTARTS AGE must-gather-operator-657fc74d64-2gg2w 1/1 Running 0 13m example-mg-gk8m8 2/2 Running 0 13sMustGatherCR을 기반으로 하는 이름이 있는 새 Pod를 생성해야 합니다. 모든 Pod의 상태는Running이어야 합니다.파일 업로드 진행 상황을 모니터링하려면 다음 명령을 실행하여 작업 Pod에서 업로드 컨테이너의 로그를 확인합니다.

oc logs -f pod/example-mg-gk8m8 -c upload성공적으로 수행되면 프로세스에서 아카이브를 생성하여 지정된 케이스에 대해 Red Hat STS(Secure File Transfer Protocol) 서버에 업로드해야 합니다.

5.2.4. MustGather 사용자 정의 리소스에 대한 구성 매개변수

데이터 수집 및 업로드 프로세스를 지정하는 YAML 파일을 생성하여 MustGather CR(사용자 정의 리소스)을 관리할 수 있습니다. 다음 표에서는 MustGather CR에서 구성할 수 있는 매개변수에 대한 개요를 제공합니다.

| 매개변수 이름 | 설명 | 유형 |

|---|---|---|

|

|

선택 사항: 감사 로그를 수집할지 여부를 지정합니다. 유효한 값은 |

|

|

|

선택 사항: |

값은 시간 단위가 있는 부동 소수점 숫자여야 합니다. 유효한 단위는 |

|

| 선택 사항: 사용할 프록시 구성을 정의합니다. 기본값은 클러스터 수준 프록시 구성으로 설정됩니다. |

|

|

| HTTP 요청에 대한 프록시의 URL을 지정합니다. | URL |

|

| HTTPS 요청의 프록시 URL을 지정합니다. | |

|

| 프록시를 사용하지 않아야 하는 쉼표로 구분된 도메인 목록을 지정합니다. | URL 목록 |

|

|

선택 사항: 데이터 수집 완료 후 |

|

|

|

선택 사항: 서비스 계정의 이름을 지정합니다. 기본값은 |

|

|

|

선택 사항: |

|

|

| 영구 볼륨의 세부 정보를 정의합니다. |

|

|

| PVC(영구 볼륨 클레임)의 세부 정보를 정의합니다. |

|

|

| 스토리지에 사용할 PVC의 이름을 지정합니다. |

|

|

| 선택 사항: 번들을 저장할 PVC 내의 경로를 지정합니다. |

|

|

|

스토리지 유형을 정의합니다. 지원되는 유일한 값은 |

|

|

|

선택 사항: |

|

|

|

선택 사항: 번들 업로드를 위한 대상 서버를 지정합니다. 기본적으로 번들은 |

기본적으로 번들은 |

|

| 진단 데이터가 수집되는 Red Hat 지원 케이스 ID를 지정합니다. |

|

|

|

Red Hat 고객 포털 지원 케이스에 파일을 인증하고 업로드하는 데 필요한 인증 정보를 정의합니다. 값에는 |

|

|

| 인증 정보가 포함된 Kubernetes 시크릿의 이름을 지정합니다. |

|

|

|

선택 사항: |

|

|

|

|

|

spec.uploadTarget 또는 spec.storage 를 지정하지 않으면 Pod가 임시 볼륨에 데이터를 저장하고 Pod가 종료되면 데이터가 영구적으로 삭제됩니다.

5.2.5. 설치 제거 지원 로그 수집

웹 콘솔을 사용하여 지원 로그 수집을 제거할 수 있습니다.

사전 요구 사항

-

cluster-admin권한이 있는 클러스터에 액세스할 수 있습니다. - OpenShift Dedicated 웹 콘솔에 액세스할 수 있습니다.

- 지원 로그 수집이 설치되어 있어야 합니다.

프로세스

- OpenShift Dedicated 웹 콘솔에 로그인합니다.

지원 로그 수집 Operator를 설치 제거합니다.

- Ecosystem → 설치된 Operators 로 이동합니다.

-

지원 로그 수집 항목 옆에 있는 옵션 메뉴

를 클릭하고 Operator 설치 제거를 클릭합니다.

를 클릭하고 Operator 설치 제거를 클릭합니다.

- 확인 대화 상자에서 설치 제거를 클릭합니다.

5.2.6. 지원 로그 수집 리소스 제거

지원 로그 수집을 제거한 후 클러스터에서 관련 리소스를 제거할 수 있습니다.

사전 요구 사항

-

cluster-admin권한이 있는 클러스터에 액세스할 수 있습니다. - OpenShift Dedicated 웹 콘솔에 액세스할 수 있습니다.

프로세스

- OpenShift Dedicated 웹 콘솔에 로그인합니다.

must-gather-operator 네임스페이스에서 구성 요소 배포를 삭제합니다.

- 프로젝트 드롭다운 메뉴를 클릭하여 사용 가능한 모든 프로젝트 목록을 보고 must-gather-operator 프로젝트를 선택합니다.

- 워크로드 → 배포로 이동합니다.

- 삭제할 배포를 선택합니다.

- 작업 드롭다운 메뉴를 클릭하고 배포 삭제 를 선택합니다.

- 확인 대화 상자에서 삭제를 클릭하여 배포를 삭제합니다.

또는 CLI(명령줄 인터페이스)를 사용하여

must-gather-operator네임스페이스에 있는 구성 요소의 배포를 삭제합니다.$ oc delete deployment -n must-gather-operator -l operators.coreos.com/support-log-gather-operator.must-gather-operator

선택 사항: 지원 로그 수집에 의해 설치된 CRD(사용자 정의 리소스 정의)를 제거합니다.

- 관리 → 클러스터 리소스 정의로 이동합니다.

-

Name 필드에

MustGather를 입력하여 CRD를 필터링합니다. 다음 각 CRD 옆에 있는 옵션 메뉴

를 클릭하고 사용자 정의 리소스 정의 삭제를 선택합니다.

를 클릭하고 사용자 정의 리소스 정의 삭제를 선택합니다.

-

MustGather

-

선택사항:

must-gather-operator네임스페이스를 제거합니다.- 관리 → 네임스페이스로 이동합니다.

-

must-gather-operator 옆에 있는 옵션 메뉴

를 클릭하고 네임스페이스 삭제 를 선택합니다.

를 클릭하고 네임스페이스 삭제 를 선택합니다.

-

확인 대화 상자에서

must-gather-operator를 입력하고 삭제 를 클릭합니다.

5.3. 클러스터 ID 검색

Red Hat 지원에 정보를 제공할 때 클러스터의 고유 식별자를 제공하는 것이 유용합니다. OpenShift Dedicated 웹 콘솔을 사용하여 클러스터 ID를 자동으로 입력할 수 있습니다. 웹 콘솔 또는 OpenShift CLI (oc)를 사용하여 클러스터 ID를 수동으로 검색할 수 있습니다.

사전 요구 사항

-

dedicated-admin역할의 사용자로 클러스터에 액세스할 수 있습니다. -

설치된 웹 콘솔 또는 OpenShift CLI(

oc)에 액세스할 수 있습니다.

프로세스

OpenShift Cluster Manager 를 사용하여 클러스터 ID를 수동으로 가져오려면 다음을 수행합니다.

- 클러스터 목록으로 이동합니다.

- 지원 케이스를 열어야 하는 클러스터 이름을 클릭합니다.

- 개요 탭의 세부 정보 섹션에 있는 Cluster ID 필드에서 값을 찾습니다.

웹 콘솔을 사용하여 지원 케이스를 열고 클러스터 ID를 자동으로 입력하려면 다음을 수행합니다.

- 툴바에서 (?) Help 를 선택하고 목록에서 피드백 공유를 선택합니다.

- 경험 창에 대해 Tell us에서 지원 케이스 열기 를 클릭합니다.

웹 콘솔을 사용하여 클러스터 ID를 수동으로 가져오려면 다음을 수행합니다.

- 홈 → 개요 로 이동합니다.

- 값은 Details 섹션의 Cluster ID 필드에서 사용 가능합니다.

OpenShift CLI (

oc)를 사용하여 클러스터 ID를 얻으려면 다음 명령을 실행합니다.$ oc get clusterversion -o jsonpath='{.items[].spec.clusterID}{"\n"}'

5.4. 클러스터 노드의 저널 로그 쿼리

개별 클러스터 노드의 /var/log 내에 journald 장치 로그 및 기타 로그를 수집할 수 있습니다.

사전 요구 사항

cluster-admin역할의 사용자로 클러스터에 액세스할 수 있어야 합니다.참고OpenShift Dedicated 배포에서 CCO(Customer Cloud Subscription) 모델을 사용하지 않는 고객은

oc adm node-logs명령을 사용할 수 없습니다.cluster-admin권한이 필요합니다.-

OpenShift CLI(

oc)가 설치되어 있습니다.

프로세스

OpenShift Dedicated 클러스터 노드에서

kubeletjournald장치 로그를 쿼리합니다. 다음 예제에서는 컨트롤 플레인 노드만 쿼리합니다.$ oc adm node-logs --role=master -u kubelet1 -

kubelet: 다른 장치 로그를 쿼리하려면 적절하게 바꿉니다.

-

클러스터 노드의

/var/log/아래에있는 특정 하위 디렉터리에서 로그를 수집합니다./var/log/하위 디렉토리에 포함된 로그 목록을 검색합니다. 다음 예제는 모든 컨트롤 플레인 노드의/var/log/openshift-apiserver/에 있는 파일을 나열합니다.$ oc adm node-logs --role=master --path=openshift-apiserver/var/log/하위 디렉터리 내의 특정 로그를 확인합니다. 다음 예제는 모든 컨트롤 플레인 노드에서/var/log/openshift-apiserver/audit.log내용을 출력합니다.$ oc adm node-logs --role=master --path=openshift-apiserver/audit.log

5.5. 네트워크 추적 방법

패킷 캡처 레코드 형태로 네트워크 추적을 수집하면 네트워크 문제 해결과 관련하여 Red Hat 지원을 지원할 수 있습니다.

OpenShift Dedicated는 네트워크 추적을 수행하는 두 가지 방법을 지원합니다. 다음 표를 검토하고 요구 사항에 맞는 방법을 선택합니다.

| 방법 | 이점 및 기능 |

|---|---|

| 호스트 네트워크 추적 수집 | 하나 이상의 노드에 동시에 지정하는 기간에 대해 패킷 캡처를 수행합니다. 지정된 기간이 충족되면 패킷 캡처 파일이 노드에서 클라이언트 시스템으로 전송됩니다. 특정 작업에서 네트워크 통신 문제를 트리거하는 이유를 해결할 수 있습니다. 패킷 캡처를 실행하고 문제를 트리거하는 작업을 수행하고 로그를 사용하여 문제를 진단합니다. |

| OpenShift Dedicated 노드 또는 컨테이너에서 네트워크 추적 수집 |

하나의 노드 또는 하나의 컨테이너에서 패킷 캡처를 수행합니다. 패킷 캡처를 수동으로 시작하고 네트워크 통신 문제를 트리거한 다음 패킷 캡처를 수동으로 중지할 수 있습니다.

이 방법은 |

5.6. 호스트 네트워크 추적 수집

네트워크 통신을 추적하고 동시에 여러 노드에서 패킷을 캡처하여 네트워크 관련 문제를 해결할 수 있습니다.

oc adm must-gather 명령과 registry.redhat.io/openshift4/network-tools-rhel8 컨테이너 이미지 조합을 사용하여 노드에서 패킷 캡처를 수집할 수 있습니다. 패킷 캡처를 분석하면 네트워크 통신 문제를 해결하는 데 도움이 될 수 있습니다.

oc adm must-gather 명령은 특정 노드의 Pod에서 tcpdump 명령을 실행하는 데 사용됩니다. tcpdump 명령은 Pod에 패킷 캡처를 기록합니다. tcpdump 명령이 종료되면 oc adm must-gather 명령은 Pod에서 패킷 캡처가 있는 파일을 클라이언트 머신으로 전송합니다.

다음 절차의 샘플 명령은 tcpdump 명령을 사용하여 패킷 캡처를 수행하는 방법을 보여줍니다. 그러나 --image 인수에 지정된 컨테이너 이미지에서 모든 명령을 실행하여 여러 노드에서 문제 해결 정보를 동시에 수집할 수 있습니다.

사전 요구 사항

cluster-admin역할의 사용자로 OpenShift Dedicated에 로그인되어 있습니다.참고OpenShift Dedicated 배포에서 CCO(Customer Cloud Subscription) 모델을 사용하지 않는 고객은

oc adm must-gather명령을 사용할 수 없습니다.cluster-admin권한이 필요합니다.-

OpenShift CLI(

oc)가 설치되어 있습니다.

프로세스

다음 명령을 실행하여 일부 노드에서 호스트 네트워크에서 패킷 캡처를 실행합니다.

$ oc adm must-gather \ --dest-dir /tmp/captures \// <.> --source-dir '/tmp/tcpdump/' \// <.> --image registry.redhat.io/openshift4/network-tools-rhel8:latest \// <.> --node-selector 'node-role.kubernetes.io/worker' \// <.> --host-network=true \// <.> --timeout 30s \// <.> -- \ tcpdump -i any \// <.> -w /tmp/tcpdump/%Y-%m-%dT%H:%M:%S.pcap -W 1 -G 300<.>

--dest-dir인수는oc adm must-gather가 클라이언트 머신의/tmp/captures와 관련된 디렉터리에 패킷 캡처를 저장하도록 지정합니다. 쓰기 가능한 디렉터리를 지정할 수 있습니다. <.>oc adm must-gather가 시작되는 디버그 Pod에서tcpdump가 실행될 때--source-dir인수는 패킷 캡처가 Pod의/tmp/tcpdump디렉터리에 일시적으로 저장되도록 지정합니다. <.>--image인수는tcpdump명령을 포함하는 컨테이너 이미지. <.>--node-selector인수 및 예제 값은 작업자 노드에서 패킷 캡처를 수행하도록 지정합니다. 또는 단일 노드에서 패킷 캡처를 실행하도록--node-name인수를 지정할 수 있습니다.--node-selector및--node-name인수를 모두 생략하면 패킷 캡처가 모든 노드에서 수행됩니다. <.> 패킷 캡처가 노드의 네트워크 인터페이스에서 수행되도록--host-network=true인수가 필요합니다. <.>--timeout인수 및 값은 디버그 Pod를 30 초 동안 실행하기 위해 지정합니다.--timeout인수와 기간을 지정하지 않으면 디버그 Pod가 10분 동안 실행됩니다. <.>tcpdump명령의-i any인수는 모든 네트워크 인터페이스에서 패킷을 캡처하도록 지정합니다. 또는 네트워크 인터페이스 이름을 지정할 수 있습니다.- 네트워크 추적에서 패킷을 캡처하는 동안 네트워크 통신 문제를 트리거하는 웹 애플리케이션 액세스와 같은 작업을 수행합니다.

oc adm must-gather가 Pod에서 클라이언트 머신으로 전송된 패킷 캡처 파일을 확인합니다.tmp/captures ├── event-filter.html ├── ip-10-0-192-217-ec2-internal1 │ └── registry-redhat-io-openshift4-network-tools-rhel8-sha256-bca... │ └── 2022-01-13T19:31:31.pcap ├── ip-10-0-201-178-ec2-internal2 │ └── registry-redhat-io-openshift4-network-tools-rhel8-sha256-bca... │ └── 2022-01-13T19:31:30.pcap ├── ip-... └── timestamp

5.7. OpenShift Dedicated 노드 또는 컨테이너에서 네트워크 추적 수집

잠재적인 네트워크 관련 OpenShift Dedicated 문제를 조사할 때 Red Hat 지원은 특정 OpenShift Dedicated 클러스터 노드 또는 특정 컨테이너에서 네트워크 패킷 추적을 요청할 수 있습니다. OpenShift Dedicated에서 네트워크 추적을 캡처하는 데 권장되는 방법은 디버그 Pod를 사용하는 것입니다.

사전 요구 사항

cluster-admin역할의 사용자로 클러스터에 액세스할 수 있어야 합니다.참고OpenShift Dedicated 배포에서 CCO(Customer Cloud Subscription) 모델을 사용하지 않는 고객은

oc debug명령을 사용할 수 없습니다.cluster-admin권한이 필요합니다.-

OpenShift CLI(

oc)가 설치되어 있습니다. - 기존 Red Hat 지원 케이스 ID가 있습니다.

프로세스

클러스터 노드 목록을 가져옵니다.

$ oc get nodes대상 노드에서 디버그 세션으로 들어갑니다. 이 단계는

<node_name>-debug라는 디버그 Pod를 인스턴스화합니다.$ oc debug node/my-cluster-node디버그 쉘 내에서

/host를 root 디렉터리로 설정합니다. 디버그 Pod는 Pod 내의/host에 호스트의 루트 파일 시스템을 마운트합니다. root 디렉토리를/host로 변경하면 호스트의 실행 경로에 포함된 바이너리를 실행할 수 있습니다.# chroot /hostchroot환경 콘솔에서 노드의 인터페이스 이름을 가져옵니다.# ip adsosreport를 실행하는 데 필요한 바이너리 및 플러그인이 포함된toolbox컨테이너를 시작합니다.# toolbox참고기존

toolboxPod가 이미 실행 중인 경우toolbox명령은'toolbox-' already exists를 출력합니다. Trying to start…를 출력합니다.tcpdump문제를 방지하려면podman rm toolbox-에서 실행중인 toolbox 컨테이너를 제거하고 새 toolbox 컨테이너를 생성합니다.클러스터 노드에서

tcpdump세션을 시작하고 출력을 캡처 파일로 리디렉션합니다. 이 예에서는ens5를 인터페이스 이름으로 사용합니다.$ tcpdump -nn -s 0 -i ens5 -w /host/var/tmp/my-cluster-node_$(date +%d_%m_%Y-%H_%M_%S-%Z).pcap1 - 1

- toolbox 컨테이너가 호스트의 root 디렉토리를

/host에 마운트하기 때문에tcpdump캡처 파일의 경로는chroot환경 외부에 있습니다.

노드의 특정 컨테이너에

tcpdump캡처가 필요한 경우 다음 단계를 따르십시오.대상 컨테이너 ID를 확인합니다. toolbox 컨테이너가 호스트의 root 디렉토리를

/host에 마운트하기 때문에chroot host명령은 이 단계에서crictl명령 보다 우선합니다.# chroot /host crictl ps컨테이너의 프로세스 ID를 확인합니다. 이 예에서 컨테이너 ID는

a7fe32346b120입니다.# chroot /host crictl inspect --output yaml a7fe32346b120 | grep 'pid' | awk '{print $2}'컨테이너에서

tcpdump세션을 시작하고 출력을 캡처 파일로 리디렉션합니다. 이 예는 컨테이너의 프로세스 ID로49,628을 사용하고 인터페이스 이름으로ens5를 사용합니다.nsenter명령은 대상 프로세스의 네임 스페이스를 입력하고 해당 네임 스페이스를 사용하여 명령을 실행합니다. 이 예에서 대상 프로세스는 컨테이너의 프로세스 ID이므로tcpdump명령은 호스트에서 컨테이너 네임 스페이스를 사용하여 실행됩니다.# nsenter -n -t 49628 -- tcpdump -nn -i ens5 -w /host/var/tmp/my-cluster-node-my-container_$(date +%d_%m_%Y-%H_%M_%S-%Z).pcap1 - 1

- toolbox 컨테이너가 호스트의 root 디렉토리를

/host에 마운트하기 때문에tcpdump캡처 파일의 경로는chroot환경 외부에 있습니다.

분석을 위해 다음 방법 중 하나를 사용하여

tcpdump캡처 파일을 Red Hat 지원팀에 제공합니다.기존 Red Hat 지원 케이스에 파일을 업로드합니다.

oc debug node/<node_name>명령을 실행하여sosreport아카이브를 연결하고 출력을 파일로 리디렉션합니다. 이 명령은 이전oc debug세션을 종료했다고 가정합니다.$ oc debug node/my-cluster-node -- bash -c 'cat /host/var/tmp/my-tcpdump-capture-file.pcap' > /tmp/my-tcpdump-capture-file.pcap1 - 1

- 디버그 컨테이너는

/host에 호스트의 root 디렉토리를 마운트합니다. 연결할 대상 파일을 지정할 때/host를 포함하여 디버그 컨테이너의 root 디렉토리에서 절대 경로를 참조합니다.

- Red Hat 고객 포털 의 고객 지원 페이지에서 기존 지원 케이스로 이동합니다.

- Attach files를 선택하고 메시지에 따라 파일을 업로드합니다.

5.8. Red Hat 지원에 진단 데이터 제공

OpenShift Dedicated 문제를 조사할 때 Red Hat 지원팀에서 지원 케이스에 진단 데이터를 업로드하도록 요청할 수 있습니다. 파일은 Red Hat 고객 포털을 통해 지원 케이스에 업로드할 수 있습니다.

사전 요구 사항

cluster-admin역할의 사용자로 클러스터에 액세스할 수 있어야 합니다.참고OpenShift Dedicated 배포에서 CCO(Customer Cloud Subscription) 모델을 사용하지 않는 고객은

oc debug명령을 사용할 수 없습니다.cluster-admin권한이 필요합니다.-

OpenShift CLI(

oc)가 설치되어 있습니다. - 기존 Red Hat 지원 케이스 ID가 있습니다.

프로세스

Red Hat 고객 포털을 통해 기존 Red Hat 지원 케이스에 진단 데이터를 업로드합니다.

oc debug node/<node_name> 명령을 사용하여 OpenShift Dedicated 노드에포함된 진단 파일을 연결하고 출력을 파일로 리디렉션합니다. 다음 예에서는/host/var/tmp/my-diagnostic-data.tar.gz를 디버그 컨테이너에서/var/tmp/my-diagnostic-data.tar.gz로 복사합니다.$ oc debug node/my-cluster-node -- bash -c 'cat /host/var/tmp/my-diagnostic-data.tar.gz' > /var/tmp/my-diagnostic-data.tar.gz1 - 1

- 디버그 컨테이너는

/host에 호스트의 root 디렉토리를 마운트합니다. 연결할 대상 파일을 지정할 때/host를 포함하여 디버그 컨테이너의 root 디렉토리에서 절대 경로를 참조합니다.

- Red Hat 고객 포털 의 고객 지원 페이지에서 기존 지원 케이스로 이동합니다.

- Attach files를 선택하고 메시지에 따라 파일을 업로드합니다.

5.9. toolbox정보

toolbox는 RHCOS(Red Hat Enterprise Linux CoreOS) 시스템에서 컨테이너를 시작하는 툴입니다. 이 툴은 주로 sosreport 와 같은 명령을 실행하는 데 필요한 필수 바이너리 및 플러그인이 포함된 컨테이너를 시작하는 데 사용됩니다.

toolbox 컨테이너의 주요 목적은 진단 정보를 수집하여 Red Hat 지원에 제공하는 것입니다. 그러나 추가 진단 도구가 필요한 경우 RPM 패키지를 추가하거나 표준 지원 도구 이미지의 대체 이미지를 실행할 수 있습니다.

5.9.1. toolbox 컨테이너에 패키지 설치

기본적으로 toolbox 명령을 실행하면 registry.redhat.io/rhel9/support-tools:latest 이미지로 컨테이너를 시작합니다. 이 이미지에는 가장 자주 사용되는 지원 도구가 포함되어 있습니다. 이미지에 포함되지 않은 지원 툴이 필요한 노드별 데이터를 수집해야 하는 경우 추가 패키지를 설치할 수 있습니다.

사전 요구 사항

-

oc debug node/<node_name>명령이 있는 노드에 액세스하고 있습니다. - root 권한이 있는 사용자로 시스템에 액세스할 수 있습니다.

프로세스

디버그 쉘 내에서

/host를 root 디렉터리로 설정합니다. 디버그 Pod는 Pod 내의/host에 호스트의 루트 파일 시스템을 마운트합니다. root 디렉토리를/host로 변경하면 호스트의 실행 경로에 포함된 바이너리를 실행할 수 있습니다.# chroot /hosttoolbox 컨테이너를 시작합니다.

# toolboxwget과 같은 추가 패키지를 설치합니다.# dnf install -y <package_name>

5.9.2. toolbox를 사용하여 대체 이미지 시작

기본적으로 toolbox 명령을 실행하면 registry.redhat.io/rhel9/support-tools:latest 이미지로 컨테이너를 시작합니다.

.toolboxrc 파일을 생성하고 실행할 이미지를 지정하여 대체 이미지를 시작할 수 있습니다. 그러나 이전 버전의 support-tools 이미지(예: registry.redhat.io/rhel8/support-tools:latest )는 OpenShift Dedicated 4에서 지원되지 않습니다.

사전 요구 사항

-

oc debug node/<node_name>명령이 있는 노드에 액세스하고 있습니다. - root 권한이 있는 사용자로 시스템에 액세스할 수 있습니다.

프로세스

디버그 쉘 내에서

/host를 root 디렉터리로 설정합니다. 디버그 Pod는 Pod 내의/host에 호스트의 루트 파일 시스템을 마운트합니다. root 디렉토리를/host로 변경하면 호스트의 실행 경로에 포함된 바이너리를 실행할 수 있습니다.# chroot /host선택 사항: 기본 이미지 대신 대체 이미지를 사용해야 하는 경우 root 사용자 ID의 홈 디렉터리에

.toolboxrc파일을 생성하고 이미지 메타데이터를 지정합니다.REGISTRY=quay.io1 IMAGE=fedora/fedora:latest2 TOOLBOX_NAME=toolbox-fedora-latest3 다음 명령을 입력하여 toolbox 컨테이너를 시작합니다.

# toolbox참고기존

toolboxPod가 이미 실행 중인 경우toolbox명령은'toolbox-' already exists를 출력합니다. Trying to start…를 출력합니다.sosreport플러그인 문제를 방지하려면podman rm toolbox-에서 실행중인 toolbox 컨테이너를 제거한 다음 새 toolbox 컨테이너를 생성합니다.

6장. 클러스터 사양 요약

6.1. 클러스터 버전 오브젝트를 사용하여 클러스터 사양 요약

clusterversion 리소스를 쿼리하여 OpenShift Dedicated 클러스터 사양 요약을 가져올 수 있습니다.

사전 요구 사항

-

dedicated-admin역할의 사용자로 클러스터에 액세스할 수 있습니다. -

OpenShift CLI(

oc)가 설치되어 있습니다.

프로세스

클러스터 버전, 가용성, 가동 시간 및 일반 상태를 쿼리합니다.

$ oc get clusterversion출력 예

NAME VERSION AVAILABLE PROGRESSING SINCE STATUS version 4.13.8 True False 8h Cluster version is 4.13.8클러스터 사양, 업데이트 가용성 및 업데이트 기록에 대한 자세한 요약을 가져옵니다.

$ oc describe clusterversion출력 예

Name: version Namespace: Labels: <none> Annotations: <none> API Version: config.openshift.io/v1 Kind: ClusterVersion # ... Image: quay.io/openshift-release-dev/ocp-release@sha256:a956488d295fe5a59c8663a4d9992b9b5d0950f510a7387dbbfb8d20fc5970ce URL: https://access.redhat.com/errata/RHSA-2023:4456 Version: 4.13.8 History: Completion Time: 2023-08-17T13:20:21Z Image: quay.io/openshift-release-dev/ocp-release@sha256:a956488d295fe5a59c8663a4d9992b9b5d0950f510a7387dbbfb8d20fc5970ce Started Time: 2023-08-17T12:59:45Z State: Completed Verified: false Version: 4.13.8 # ...

7장. 문제 해결

7.1. Google Cloud 클러스터 배포에서 OpenShift Dedicated 문제 해결

Google Cloud 클러스터 배포의 OpenShift Dedicated는 할당량 제한 및 설정 부족, 잘못 입력된 데이터, 호환되지 않는 구성 등을 포함하여 여러 가지 이유로 발생할 수 있습니다.

다음 섹션에서 Google Cloud 클러스터 설치 오류에서 일반적인 OpenShift Dedicated를 해결하는 방법을 알아보십시오.

7.1.1. Google Cloud 설치 오류 코드 문제 해결

다음 표에는 Google Cloud 설치 오류 코드의 OpenShift Dedicated와 이러한 오류를 해결하기 위해 수행할 수 있는 작업이 나열되어 있습니다.

| 오류 코드 | 설명 | 해결 |

|---|---|---|

| OCM3022 | 잘못된 Google Cloud 프로젝트 ID입니다. | Google 클라우드 콘솔에서 프로젝트 ID를 확인하고 클러스터 생성을 다시 시도합니다. |

| OCM3023 | Google Cloud 인스턴스 유형을 찾을 수 없습니다. | 인스턴스 유형을 확인하고 클러스터 생성을 재시도합니다. Google Cloud 인스턴스 유형의 OpenShift Dedicated에 대한 자세한 내용은 추가 리소스 섹션의 Google Cloud 인스턴스 유형을 참조하십시오. |

| OCM3024 | Google Cloud 사전 조건이 실패했습니다. | 조직 정책 제약 조건을 확인하고 클러스터 생성을 재시도합니다. 조직 정책 제약 조건에 대한 자세한 내용은 조직 정책 제약 조건 을 참조하십시오. |

| OCM3025 | Google Cloud SSD 할당량 제한이 초과되었습니다. |

Google Cloud 콘솔 또는 영구 디스크 SSD 할당량 관리에 대한 자세한 내용은 할당 할당량을 참조하십시오. |

| OCM3026 | Google Cloud 컴퓨팅 할당량 제한이 초과되었습니다. | CPU 컴퓨팅 할당량을 늘리고 클러스터 설치를 다시 시도합니다. CPU 컴퓨팅 할당량에 대한 자세한 내용은 Compute Engine 할당량 및 제한 개요를 참조하십시오. |

| OCM3027 | Google Cloud 서비스 계정 할당량 제한이 초과되었습니다. | 할당량에서 사용되지 않는 추가 서비스 계정을 허용하는지 확인합니다. Google Cloud 계정에서 현재 할당량 사용량을 확인하고 다시 시도하십시오. 할당량 관리에 대한 자세한 내용은 콘솔을 사용하여 할당량 관리를 참조하십시오. |

7.2. 노드 상태 확인

7.2.1. 노드 상태, 리소스 사용량 및 구성 확인

클러스터 노드 상태, 리소스 사용량 통계 및 노드 로그를 확인합니다. 또한 개별 노드에서 kubelet 상태를 쿼리합니다.

사전 요구 사항

-

dedicated-admin역할의 사용자로 클러스터에 액세스할 수 있습니다. -

OpenShift CLI(

oc)가 설치되어 있습니다.

프로세스

클러스터의 모든 노드 이름, 상태 및 역할을 나열합니다.

$ oc get nodes클러스터 내의 각 노드에 대한 CPU 및 메모리 사용량을 요약합니다.

$ oc adm top nodes특정 노드의 CPU 및 메모리 사용량을 요약합니다.

$ oc adm top node my-node

7.3. Operator 문제 해결

Operator는 OpenShift Dedicated 애플리케이션을 패키징, 배포 및 관리하는 방법입니다. 소프트웨어 벤더 엔지니어링 팀의 확장 기능으로 OpenShift Dedicated 환경을 모니터링하고 현재 상태를 사용하여 실시간으로 의사 결정을 내립니다. Operator는 업그레이드를 원활하게 처리하고 오류 발생에 자동으로 대응하며 시간을 절약하기 위해 소프트웨어 백업 프로세스를 생략하는 것과 같은 바로가기를 실행하지 않습니다.

OpenShift Dedicated 4에는 클러스터가 제대로 작동하는 데 필요한 기본 Operator 세트가 포함되어 있습니다. 이러한 기본 운영자는 CVO (Cluster Version Operator)에 의해 관리됩니다.

클러스터 관리자는 OpenShift Dedicated 웹 콘솔 또는 CLI를 사용하여 소프트웨어 카탈로그에서 애플리케이션 Operator를 설치할 수 있습니다. 그런 다음 Operator를 하나 이상의 네임 스페이스에 가입시켜 클러스터의 개발자가 사용할 수 있도록합니다. 애플리케이션 Operator는 OLM (Operator Lifecycle Manager)에서 관리합니다.

Operator 문제가 발생하면 Operator 서브스크립션 상태를 확인하십시오. 클러스터 전체에서 Operator Pod 상태를 확인하고 진단을 위해 Operator 로그를 수집합니다.

7.3.1. Operator 서브스크립션 상태 유형

서브스크립션은 다음 상태 유형을 보고할 수 있습니다.

| 상태 | 설명 |

|---|---|

|

| 해결에 사용되는 일부 또는 모든 카탈로그 소스가 정상 상태가 아닙니다. |

|

| 서브스크립션 설치 계획이 없습니다. |

|

| 서브스크립션 설치 계획이 설치 대기 중입니다. |

|

| 서브스크립션 설치 계획이 실패했습니다. |

|

| 서브스크립션의 종속성 확인에 실패했습니다. |

기본 OpenShift Dedicated 클러스터 Operator는 CVO(Cluster Version Operator)에 의해 관리되며 Subscription 오브젝트가 없습니다. 애플리케이션 Operator는 OLM(Operator Lifecycle Manager)에서 관리하며 Subscription 오브젝트가 있습니다.

7.3.2. CLI를 사용하여 Operator 서브스크립션 상태 보기

CLI를 사용하여 Operator 서브스크립션 상태를 볼 수 있습니다.

사전 요구 사항

-

dedicated-admin역할의 사용자로 클러스터에 액세스할 수 있습니다. -

OpenShift CLI(

oc)가 설치되어 있습니다.

프로세스

Operator 서브스크립션을 나열합니다.

$ oc get subs -n <operator_namespace>oc describe명령을 사용하여Subscription리소스를 검사합니다.$ oc describe sub <subscription_name> -n <operator_namespace>명령 출력에서 Operator 서브스크립션 조건 유형의 상태에 대한

Conditions섹션을 확인합니다. 다음 예에서 사용 가능한 모든 카탈로그 소스가 정상이므로CatalogSourcesUnhealthy조건 유형의 상태가false입니다.출력 예

Name: cluster-logging Namespace: openshift-logging Labels: operators.coreos.com/cluster-logging.openshift-logging= Annotations: <none> API Version: operators.coreos.com/v1alpha1 Kind: Subscription # ... Conditions: Last Transition Time: 2019-07-29T13:42:57Z Message: all available catalogsources are healthy Reason: AllCatalogSourcesHealthy Status: False Type: CatalogSourcesUnhealthy # ...

기본 OpenShift Dedicated 클러스터 Operator는 CVO(Cluster Version Operator)에 의해 관리되며 Subscription 오브젝트가 없습니다. 애플리케이션 Operator는 OLM(Operator Lifecycle Manager)에서 관리하며 Subscription 오브젝트가 있습니다.

7.3.3. CLI를 사용하여 Operator 카탈로그 소스 상태 보기

CLI를 사용하여 Operator 카탈로그 소스의 상태를 볼 수 있습니다.

사전 요구 사항

-

dedicated-admin역할의 사용자로 클러스터에 액세스할 수 있습니다. -

OpenShift CLI(

oc)가 설치되어 있습니다.

프로세스

네임스페이스의 카탈로그 소스를 나열합니다. 예를 들어 클러스터 전체 카탈로그 소스에 사용되는

openshift-marketplace네임스페이스를 확인할 수 있습니다.$ oc get catalogsources -n openshift-marketplace출력 예

NAME DISPLAY TYPE PUBLISHER AGE certified-operators Certified Operators grpc Red Hat 55m community-operators Community Operators grpc Red Hat 55m example-catalog Example Catalog grpc Example Org 2m25s redhat-operators Red Hat Operators grpc Red Hat 55moc describe명령을 사용하여 카탈로그 소스에 대한 자세한 내용 및 상태를 가져옵니다.$ oc describe catalogsource example-catalog -n openshift-marketplace출력 예

Name: example-catalog Namespace: openshift-marketplace Labels: <none> Annotations: operatorframework.io/managed-by: marketplace-operator target.workload.openshift.io/management: {"effect": "PreferredDuringScheduling"} API Version: operators.coreos.com/v1alpha1 Kind: CatalogSource # ... Status: Connection State: Address: example-catalog.openshift-marketplace.svc:50051 Last Connect: 2021-09-09T17:07:35Z Last Observed State: TRANSIENT_FAILURE Registry Service: Created At: 2021-09-09T17:05:45Z Port: 50051 Protocol: grpc Service Name: example-catalog Service Namespace: openshift-marketplace # ...앞의 예제 출력에서 마지막으로 관찰된 상태는

TRANSIENT_FAILURE입니다. 이 상태는 카탈로그 소스에 대한 연결을 설정하는 데 문제가 있음을 나타냅니다.카탈로그 소스가 생성된 네임스페이스의 Pod를 나열합니다.

$ oc get pods -n openshift-marketplace출력 예

NAME READY STATUS RESTARTS AGE certified-operators-cv9nn 1/1 Running 0 36m community-operators-6v8lp 1/1 Running 0 36m marketplace-operator-86bfc75f9b-jkgbc 1/1 Running 0 42m example-catalog-bwt8z 0/1 ImagePullBackOff 0 3m55s redhat-operators-smxx8 1/1 Running 0 36m카탈로그 소스가 네임스페이스에 생성되면 해당 네임스페이스에 카탈로그 소스의 Pod가 생성됩니다. 위 예제 출력에서

example-catalog-bwt8zpod의 상태는ImagePullBackOff입니다. 이 상태는 카탈로그 소스의 인덱스 이미지를 가져오는 데 문제가 있음을 나타냅니다.자세한 정보는

oc describe명령을 사용하여 Pod를 검사합니다.$ oc describe pod example-catalog-bwt8z -n openshift-marketplace출력 예

Name: example-catalog-bwt8z Namespace: openshift-marketplace Priority: 0 Node: ci-ln-jyryyg2-f76d1-ggdbq-worker-b-vsxjd/10.0.128.2 ... Events: Type Reason Age From Message ---- ------ ---- ---- ------- Normal Scheduled 48s default-scheduler Successfully assigned openshift-marketplace/example-catalog-bwt8z to ci-ln-jyryyf2-f76d1-fgdbq-worker-b-vsxjd Normal AddedInterface 47s multus Add eth0 [10.131.0.40/23] from openshift-sdn Normal BackOff 20s (x2 over 46s) kubelet Back-off pulling image "quay.io/example-org/example-catalog:v1" Warning Failed 20s (x2 over 46s) kubelet Error: ImagePullBackOff Normal Pulling 8s (x3 over 47s) kubelet Pulling image "quay.io/example-org/example-catalog:v1" Warning Failed 8s (x3 over 47s) kubelet Failed to pull image "quay.io/example-org/example-catalog:v1": rpc error: code = Unknown desc = reading manifest v1 in quay.io/example-org/example-catalog: unauthorized: access to the requested resource is not authorized Warning Failed 8s (x3 over 47s) kubelet Error: ErrImagePull앞의 예제 출력에서 오류 메시지는 권한 부여 문제로 인해 카탈로그 소스의 인덱스 이미지를 성공적으로 가져오지 못한 것으로 표시됩니다. 예를 들어 인덱스 이미지는 로그인 인증 정보가 필요한 레지스트리에 저장할 수 있습니다.

7.3.4. Operator Pod 상태 쿼리

클러스터 내의 Operator Pod 및 해당 상태를 나열할 수 있습니다. 자세한 Operator Pod 요약을 수집할 수도 있습니다.

사전 요구 사항

-

dedicated-admin역할의 사용자로 클러스터에 액세스할 수 있습니다. - API 서비스가 작동하고 있어야 합니다.

-

OpenShift CLI(

oc)가 설치되어 있습니다.

프로세스

클러스터에서 실행중인 Operator를 나열합니다. 출력에는 Operator 버전, 가용성 및 가동 시간 정보가 포함됩니다.

$ oc get clusteroperatorsOperator의 네임스페이스에서 실행 중인 Operator Pod와 Pod 상태, 재시작, 경과 시간을 표시합니다.

$ oc get pod -n <operator_namespace>자세한 Operator Pod 요약을 출력합니다.

$ oc describe pod <operator_pod_name> -n <operator_namespace>

7.3.5. Operator 로그 수집

Operator 문제가 발생하면 Operator Pod 로그에서 자세한 진단 정보를 수집할 수 있습니다.

사전 요구 사항

-

dedicated-admin역할의 사용자로 클러스터에 액세스할 수 있습니다. - API 서비스가 작동하고 있어야 합니다.

-

OpenShift CLI(

oc)가 설치되어 있습니다. - 컨트롤 플레인 또는 컨트롤 플레인 시스템의 정규화된 도메인 이름이 있어야 합니다.

프로세스

Operator의 네임스페이스에서 실행 중인 Operator Pod와 Pod 상태, 재시작, 경과 시간을 표시합니다.

$ oc get pods -n <operator_namespace>Operator Pod의 로그를 검토합니다.

$ oc logs pod/<pod_name> -n <operator_namespace>Operator Pod에 컨테이너가 여러 개 있는 경우 위 명령에 의해 각 컨테이너의 이름이 포함된 오류가 생성됩니다. 개별 컨테이너의 로그를 쿼리합니다.

$ oc logs pod/<operator_pod_name> -c <container_name> -n <operator_namespace>API가 작동하지 않는 경우 대신 SSH를 사용하여 각 컨트롤 플레인 노드에서 Operator Pod 및 컨테이너 로그를 검토합니다.

<master-node>.<cluster_name>.<base_domain>을 적절한 값으로 바꿉니다.각 컨트롤 플레인 노드에 Pod를 나열합니다.

$ ssh core@<master-node>.<cluster_name>.<base_domain> sudo crictl podsReady상태가 표시되지 않는 Operator Pod의 경우 Pod 상태를 자세히 검사합니다.<operator_pod_id>를 이전 명령의 출력에 나열된 Operator Pod의 ID로 교체합니다.$ ssh core@<master-node>.<cluster_name>.<base_domain> sudo crictl inspectp <operator_pod_id>Operator Pod와 관련된 컨테이너를 나열합니다.

$ ssh core@<master-node>.<cluster_name>.<base_domain> sudo crictl ps --pod=<operator_pod_id>Ready상태가 표시되지 않는 Operator 컨테이너의 경우 컨테이너 상태를 자세히 검사합니다.<container_id>를 이전 명령의 출력에 나열된 컨테이너 ID로 바꿉니다.$ ssh core@<master-node>.<cluster_name>.<base_domain> sudo crictl inspect <container_id>Ready상태가 표시되지 않는 Operator 컨테이너의 로그를 확인합니다.<container_id>를 이전 명령의 출력에 나열된 컨테이너 ID로 바꿉니다.$ ssh core@<master-node>.<cluster_name>.<base_domain> sudo crictl logs -f <container_id>참고RHCOS(Red Hat Enterprise Linux CoreOS)를 실행하는 OpenShift Dedicated 4 클러스터 노드는 변경할 수 없으며 Operator를 사용하여 클러스터 변경 사항을 적용합니다. SSH를 사용하여 클러스터 노드에 액세스하는 것은 권장되지 않습니다. SSH를 통해 진단 데이터를 수집하기 전에

oc adm must gather및 기타oc명령을 실행하여 충분한 데이터를 수집할 수 있는지 확인하십시오. 그러나 OpenShift Dedicated API를 사용할 수 없거나 kubelet이 대상 노드에서 제대로 작동하지 않는 경우oc작업이 영향을 받습니다. 이러한 상황에서ssh core@<node>.<cluster_name>.<base_domain>을 사용하여 노드에 액세스할 수 있습니다.

7.4. Pod 문제 조사

OpenShift Dedicated는 하나의 호스트에 함께 배포되는 하나 이상의 컨테이너인 Pod의 Kubernetes 개념을 활용합니다. Pod는 OpenShift Dedicated 4에서 정의, 배포 및 관리할 수 있는 최소 컴퓨팅 단위입니다.

Pod가 정의되면 컨테이너가 종료될 때까지 또는 제거될 때까지 노드에서 실행되도록 할당됩니다. 정책 및 종료 코드에 따라 Pod는 종료 후 제거되거나 로그에 액세스할 수 있도록 유지됩니다.

Pod 문제 발생 시 가장 먼저 Pod의 상태를 확인합니다. Pod의 명시적인 오류가 발생한 경우에는 Pod의 오류 상태를 확인하여 특정 이미지, 컨테이너 또는 Pod 네트워크 문제를 파악합니다. 오류 상태에 따라 진단 데이터를 수집합니다. Pod 이벤트 메시지와 Pod 및 컨테이너 로그 정보를 확인합니다. 명령줄에서 실행 중인 Pod에 액세스하여 문제를 동적으로 진단하거나 문제가 있는 Pod의 배포 구성을 기반으로 루트 액세스 권한으로 디버그 Pod를 시작합니다.

7.4.1. Pod 오류 상태 이해

Pod에서 오류가 발생하면 명시적 오류 상태를 반환하며 oc get Pods 출력의 status 필드에서 확인할 수 있습니다. Pod 오류 상태에는 이미지, 컨테이너 및 컨테이너 네트워크 관련 오류가 포함됩니다.

다음 표에는 Pod 오류 상태 및 설명이 기재되어 있습니다.

| Pod 오류 상태 | 설명 |

|---|---|

|

| 일반 이미지 검색 오류입니다. |

|

| 이미지 검색에 실패하여 백 오프되었습니다. |

|

| 지정된 이미지 이름이 잘못되었습니다. |

|

| 이미지 검사에 실패했습니다. |

|

|

|

|

| 레지스트리에서 이미지 검색을 시도할 때 HTTP 오류가 발생했습니다. |

|

| 지정된 컨테이너가 선언된 Pod에 존재하지 않거나 kubelet에 의해 관리되지 않습니다. |

|

| 컨테이너 초기화에 실패했습니다. |

|

| Pod의 컨테이너가 정상적으로 시작되지 않았습니다. |

|

| Pod의 컨테이너가 정상적으로 종료되지 않았습니다. |

|

| 컨테이너가 종료되었습니다. kubelet은 재시작을 시도하지 않습니다. |

|

| 컨테이너 또는 이미지가 root 권한으로 실행하려고 했습니다. |

|

| Pod 샌드 박스 생성에 실패했습니다. |

|

| Pod 샌드 박스 구성을 가져오지 못했습니다. |

|

| Pod의 샌드박스가 정상적으로 중지되지 않았습니다. |

|

| 네트워크 초기화에 실패했습니다. |

|

| 네트워크 종료에 실패했습니다. |

7.4.2. Pod 상태 검토