アプリケーションのビルド

OpenShift Container Platform でのアプリケーションの作成および管理

概要

第1章 アプリケーションのビルドの概要

OpenShift Container Platform を使用すると、Web コンソールまたはコマンドラインインターフェイス (CLI) を使用してアプリケーションを作成、編集、削除、および管理できます。

1.1. プロジェクトの使用

プロジェクトを使用すると、アプリケーションを分離して編成および管理できます。OpenShift Container Platform で、プロジェクトの作成、表示、削除 などを含め、プロジェクトライフサイクル全体を管理できます。

プロジェクトを作成したら、Developer パースペクティブを使用して、ユーザーに対して プロジェクトへのアクセス権の付与または取り消し と クラスターロールの管理 を行えます。また、新規プロジェクトの自動プロビジョニングに使用されるプロジェクトテンプレートを作成する際に、プロジェクト設定リソースの編集 も行えます。

CLI を使用して、OpenShift Container Platform API へのリクエストを借用して 別のユーザーとしてプロジェクトを作成 できます。新規プロジェクトの作成をリクエストすると、OpenShift Container Platform はエンドポイントを使用して、カスタマイズ可能なテンプレートに従ってプロジェクトをプロビジョニングします。クラスター管理者は、認証されたユーザーグループによる新規プロジェクトのセルフプロビジョニングを阻止 することを選択できます。

1.2. アプリケーションの使用

1.2.1. アプリケーションの作成

アプリケーションを作成するには、プロジェクトを作成しているか、適切なロールとパーミッションでプロジェクトにアクセスできる必要があります。Web コンソールの Developer パースペクティブ、インストール済みの Operator、OpenShift Container Platform CLI のいずれかを使用してアプリケーションを作成できます。プロジェクトに追加するアプリケーションは、Git、JAR ファイル、devfile、または開発者カタログから入手できます。

ソースまたはバイナリーコード、イメージ、およびテンプレートを含むコンポーネントを使用し、OpenShift Container Platform CLI を使用してアプリケーションを作成することもできます。OpenShift Container Platform Web コンソールを使用すると、クラスター管理者によってインストールされた Operator からアプリケーションを作成できます。

1.2.2. アプリケーションの保守

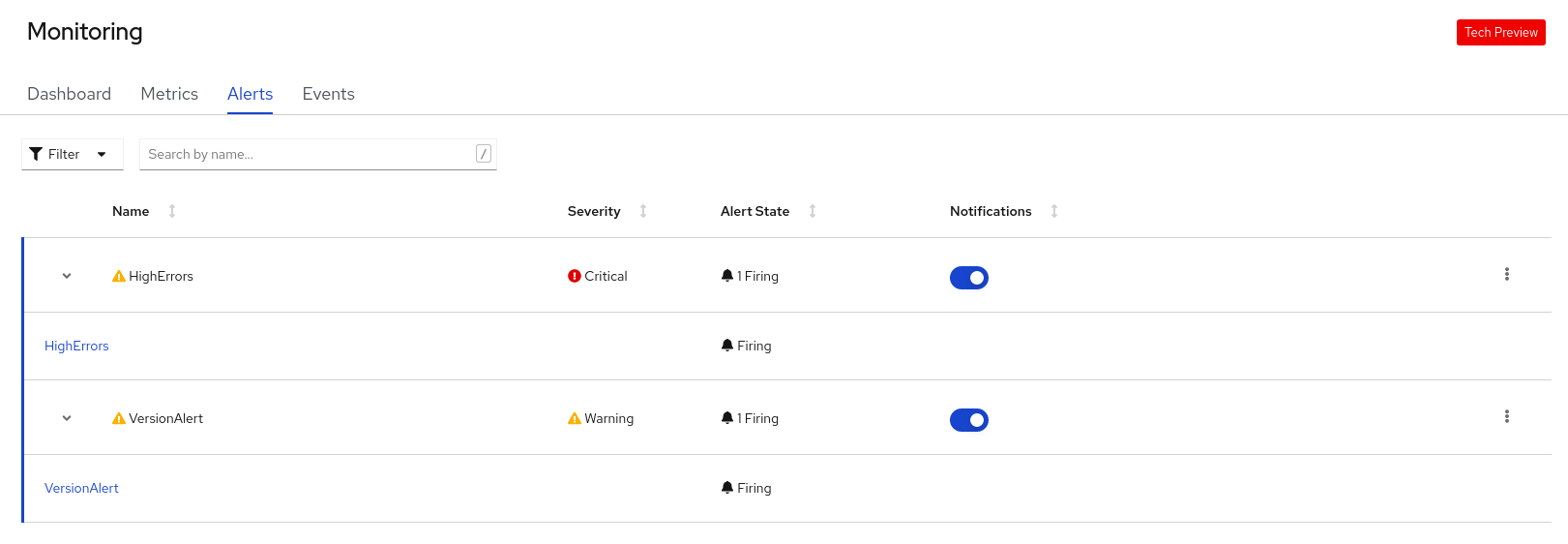

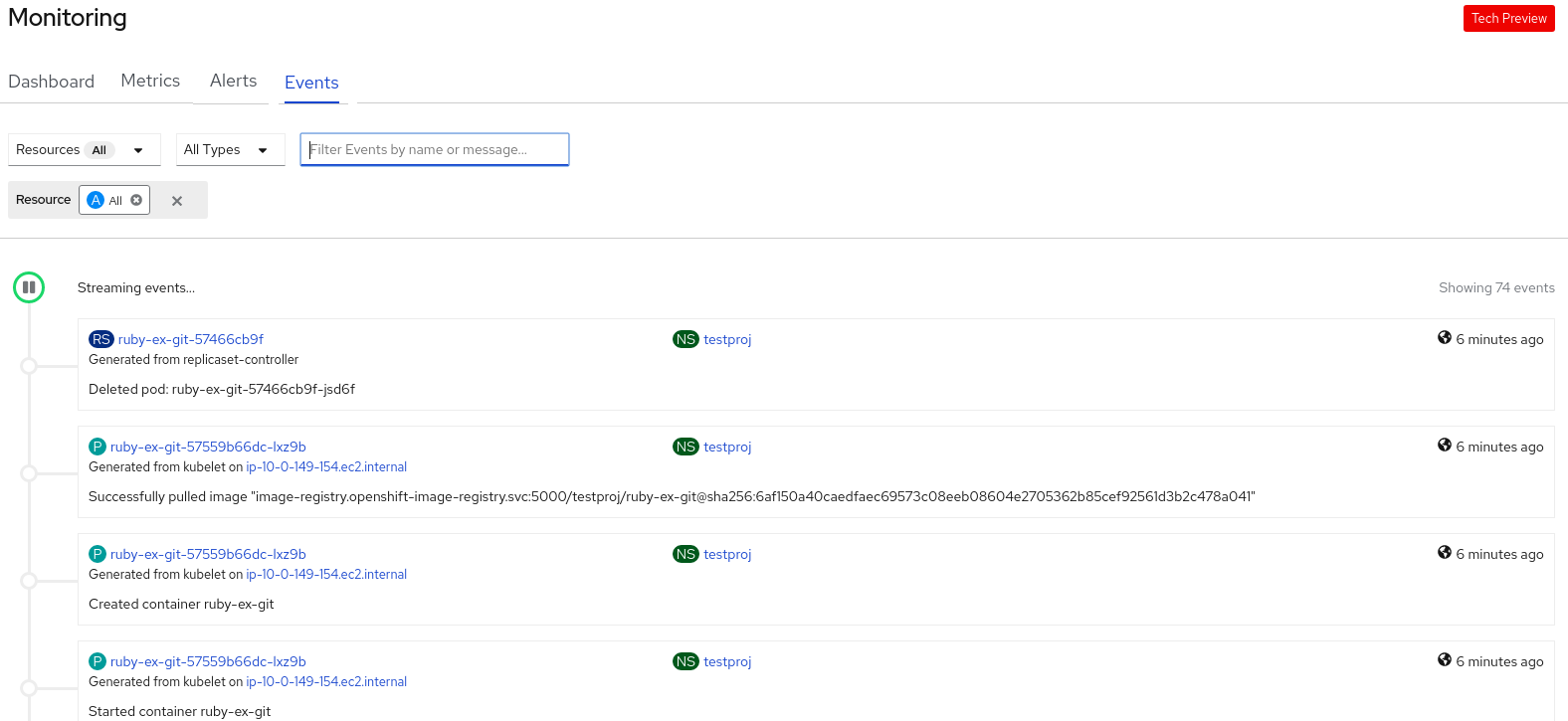

アプリケーションを作成したら、Web コンソールを使用して プロジェクトまたはアプリケーションのメトリックを監視 できます。Web コンソールを使用して、アプリケーションを 編集 または 削除 することもできます。アプリケーションの実行中は、すべてのアプリケーションリソースが使用されるわけではありません。クラスター管理者は、スケーラブルなリソースをアイドル状態 にして、リソースの消費を減らすことができます。

1.2.3. アプリケーションのサービスへの接続

アプリケーションはバッキングサービスを使用して、サービスプロバイダーに応じて異なるワークロードを構築および接続します。開発者として Service Binding Operator を使用すると、手作業でバインディング接続を設定する手順なしに、Operator が管理するバッキングサービスとワークロードを簡単にバインドできます。IBM Power Systems、IBM Z、および LinuxONE 環境 にもサービスバインディングを適用できます。

1.2.4. アプリケーションのデプロイ

Deployment または DeploymentConfig オブジェクトを使用してアプリケーションをデプロイし、Web コンソールからそれらを 管理 できます。アプリケーションの変更またはアップグレード中のダウンタイムを短縮するのに役立つ デプロイメントストラテジー を作成できます。

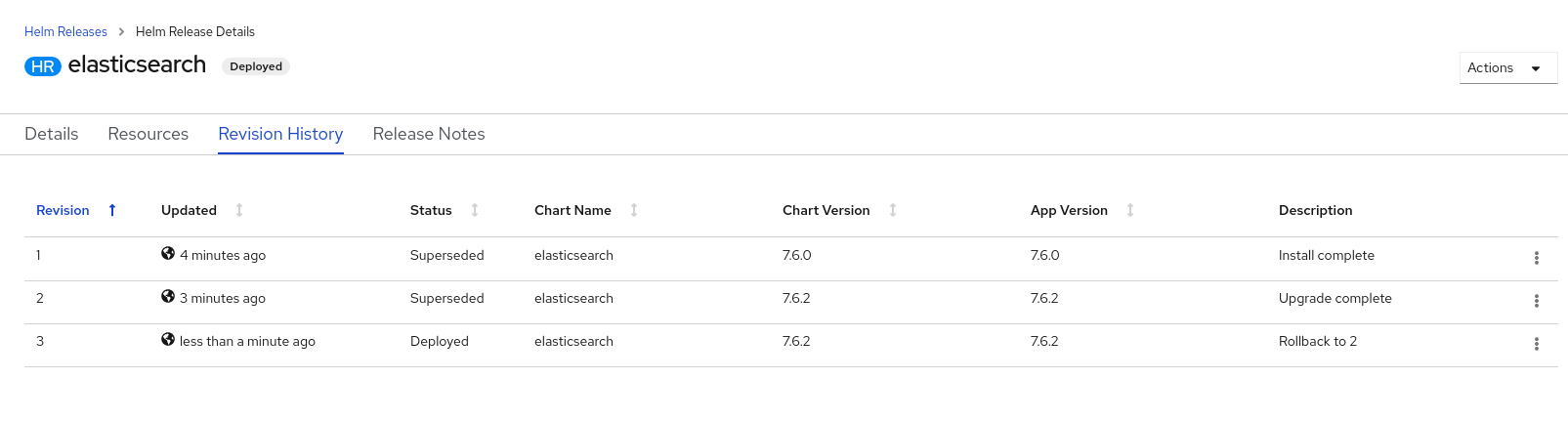

アプリケーションやサービスの OpenShift Container Platform クラスターへのデプロイメントを単純化するソフトウェアパッケージマネージャーである Helm も使用できます。

1.3. Red Hat Marketplace の使用

Red Hat Marketplace は、パブリッククラウドおよびオンプレミスで実行されるコンテナーベース環境向けの認定されたソフトウェアの検出とアクセスが可能なオープンクラウドマーケットプレースです。

第2章 プロジェクト

2.1. プロジェクトの使用

プロジェクト を使用することにより、あるユーザーコミュニティーは、他のコミュニティーと切り離された状態で独自のコンテンツを整理し、管理することができます。

openshift- および kube- で始まる名前のプロジェクトは デフォルトプロジェクト です。これらのプロジェクトは、Pod として実行されるクラスターコンポーネントおよび他のインフラストラクチャーコンポーネントをホストします。そのため、OpenShift Container Platform では oc new-project コマンドを使用して openshift- または kube- で始まる名前のプロジェクトを作成することができません。クラスター管理者は、oc adm new-project コマンドを使用してこれらのプロジェクトを作成できます。

デフォルト namespace (default、kube-system、kube-public、openshift-node、openshift-infra、openshift) のいずれかに作成された Pod に SCC を割り当てることはできません。これらの namespace は Pod またはサービスを実行するために使用することはできません。

2.1.1. Web コンソールを使用したプロジェクトの作成

クラスター管理者が許可する場合、新規プロジェクトを作成できます。

openshift- および kube- で始まる名前のプロジェクトは OpenShift Container Platform によって重要 (Critical) と見なされます。そのため、OpenShift Container Platform では、Web コンソールを使用して openshift- で始まる名前のプロジェクトを作成することはできません。

デフォルト namespace (default、kube-system、kube-public、openshift-node、openshift-infra、openshift) のいずれかに作成された Pod に SCC を割り当てることはできません。これらの namespace は Pod またはサービスを実行するために使用することはできません。

手順

- Home → Projects に移動します。

- Create Project をクリックします。

- プロジェクトの詳細を入力します。

- Create をクリックします。

2.1.2. Web コンソールでの開発者パースペクティブを使用したプロジェクトの作成

OpenShift Container Platform Web コンソールの Developer パースペクティブを使用し、クラスターでプロジェクトを作成できます。

openshift- および kube- で始まる名前のプロジェクトは OpenShift Container Platform によって重要 (Critical) と見なされます。そのため、OpenShift Container Platform では、Developer パーステクティブを使用して、 openshift- または kube- で始まる名前のプロジェクトを作成することはできません。クラスター管理者は、oc adm new-project コマンドを使用してこれらのプロジェクトを作成できます。

デフォルト namespace (default、kube-system、kube-public、openshift-node、openshift-infra、openshift) のいずれかに作成された Pod に SCC を割り当てることはできません。これらの namespace は Pod またはサービスを実行するために使用することはできません。

前提条件

- OpenShift Container Platform のプロジェクト、アプリケーション、および他のワークロードを作成するために適切なロールおよびパーミッションがあることを確認します。

手順

以下のように、Developer パースペクティブを使用してプロジェクトを作成できます。

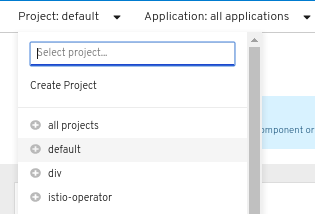

Project ドロップダウンメニューをクリックし、利用可能なすべてのプロジェクトのリストを表示します。Create Project を選択します。

図2.1 Create project

-

Create Project ダイアログボックスで、Name フィールドに、

myprojectなどの一意の名前を入力します。 - オプション: プロジェクトの Display Name および Description の詳細を追加します。

- Create をクリックします。

- 左側のナビゲーションパネルを使用して Project ビューに移動し、プロジェクトのダッシュボードを確認します。

オプション。

- 画面上部の Project ドロップダウンメニューで、all projects を選択し、クラスターのすべてのプロジェクトをリスト表示します。

- Details タブを使用してプロジェクトの詳細を表示します。

- プロジェクトに対する適切なパーミッションがある場合は、Project Access タブを使用して、プロジェクトの administrator、edit、および view 権限を提供するか、取り消します。

2.1.3. CLI を使用したプロジェクトの作成

クラスター管理者が許可する場合、新規プロジェクトを作成できます。

openshift- および kube- で始まる名前のプロジェクトは OpenShift Container Platform によって重要 (Critical) と見なされます。そのため、OpenShift Container Platform では oc new-project コマンドを使用して openshift- または kube- で始まる名前のプロジェクトを作成することができません。クラスター管理者は、oc adm new-project コマンドを使用してこれらのプロジェクトを作成できます。

デフォルト namespace (default、kube-system、kube-public、openshift-node、openshift-infra、openshift) のいずれかに作成された Pod に SCC を割り当てることはできません。これらの namespace は Pod またはサービスを実行するために使用することはできません。

手順

以下を実行します。

$ oc new-project <project_name> \ --description="<description>" --display-name="<display_name>"以下に例を示します。

$ oc new-project hello-openshift \ --description="This is an example project" \ --display-name="Hello OpenShift"

作成できるプロジェクトの数は、システム管理者によって制限される場合があります。上限に達すると、新規プロジェクトを作成できるように既存プロジェクトを削除しなければならない場合があります。

2.1.4. Web コンソールを使用したプロジェクトの表示

手順

- Home → Projects に移動します。

表示するプロジェクトを選択します。

このページで、Workloads をクリックして、プロジェクトのワークロードを確認します。

2.1.5. CLI を使用したプロジェクトの表示

プロジェクトを表示する際は、認証ポリシーに基づいて、表示アクセスのあるプロジェクトだけを表示できるように制限されます。

手順

プロジェクトのリストを表示するには、以下を実行します。

$ oc get projectsCLI 操作について現在のプロジェクトから別のプロジェクトに切り換えることができます。その後の操作についてはすべて指定のプロジェクトが使用され、プロジェクトスコープのコンテンツの操作が実行されます。

$ oc project <project_name>

2.1.6. 開発者パースペクティブを使用したプロジェクトに対するアクセスパーミッションの提供

Developer パースペクティブで Project ビューを使用し、プロジェクトに対するアクセスを付与したり、取り消したりできます。

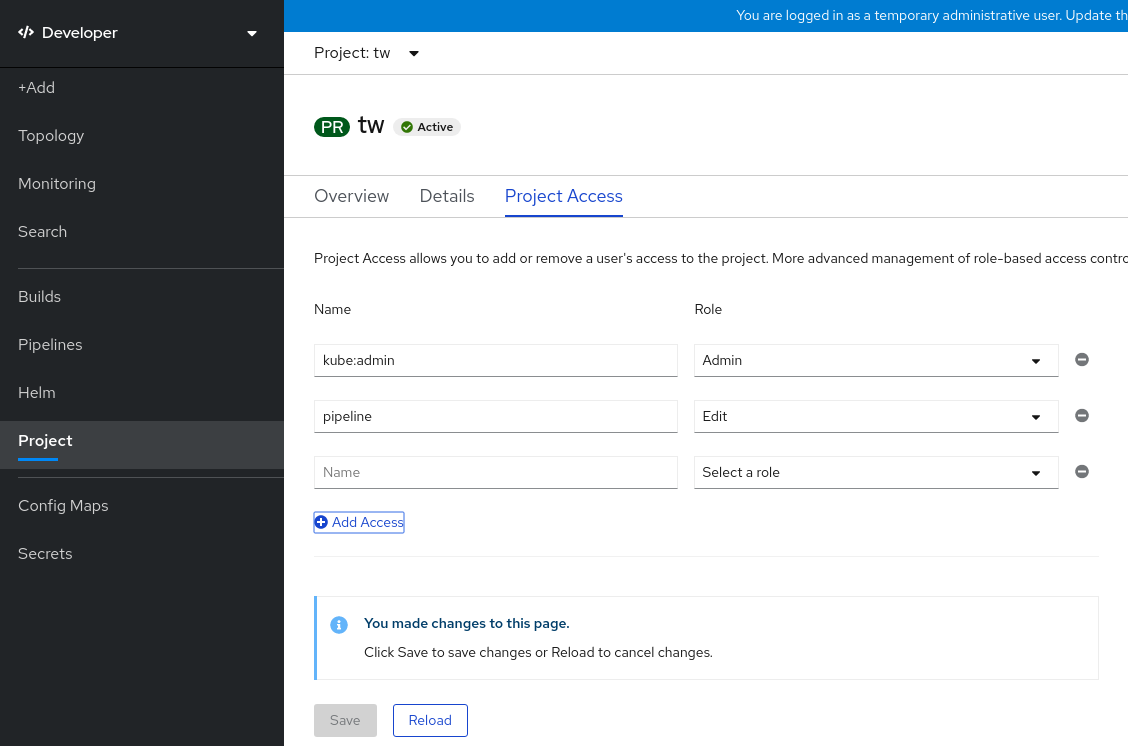

手順

ユーザーをプロジェクトに追加し、Admin、Edit、または View アクセスをユーザーに付与するには、以下を実行します。

- Developer パースペクティブで、Project ビューに移動します。

- Project ページで、Project Access タブを選択します。

Add Access をクリックして、パーミッションの新規の行をデフォルトパーミッションに追加します。

図2.2 プロジェクトパーミッション

- ユーザー名を入力し、Select a role ドロップダウンリストをクリックし、適切なロールを選択します。

- Save をクリックして新規パーミッションを追加します。

以下を使用することもできます。

- Select a role ドロップダウンリストを使用して、既存ユーザーのアクセスパーミッションを変更できます。

- Remove Access アイコンを使用して、既存ユーザーのプロジェクトへのアクセスパーミッションを完全に削除できます。

高度なロールベースのアクセス制御は、Administrator パースペクティブの Roles および Roles Binding ビューで管理されます。

2.1.7. 開発者パースペクティブを使用した利用可能なクラスターロールのカスタマイズ

プロジェクトのユーザーは、アクセス制御に基づいてクラスターロールに割り当てられます。Project → Project access → Role の順に移動して、これらのクラスターロールにアクセスできます。デフォルトでは、これらのロールは Admin、Edit、および View です。

プロジェクトのクラスターロールを追加または編集するには、クラスターの YAML コードをカスタマイズできます。

手順

プロジェクトの異なるクラスターロールをカスタマイズするには、以下を実行します。

-

Search ビューで、Resources ドロップダウンリストを使用して

Consoleを検索します。 利用可能なオプションから、Console

operator.openshift.io/v1を選択します。図2.3 コンソールリソースの検索

- Name リストで cluster を選択します。

- YAML タブに移動し、YAML コードを表示し、編集します。

specの YAML コードで、availableClusterRolesの一覧を追加または編集し、変更を保存します。spec: customization: projectAccess: availableClusterRoles: - admin - edit - view

2.1.8. プロジェクトへの追加

手順

- Web コンソールのナビゲーションメニューの上部にあるコンテキストセレクターから Developer を選択します。

- +Add をクリックします。

- ページの上部で、追加するプロジェクトの名前を選択します。

- プロジェクトに追加する方法をクリックし、ワークフローに従います。

また、クイック検索を使用してコンポーネントをトポロジーに追加することもできます。

2.1.9. Web コンソールを使用したプロジェクトステータスの確認

手順

- Home → Projects に移動します。

- ステータスを確認するプロジェクトを選択します。

2.1.10. CLI を使用したプロジェクトステータスの確認

手順

以下を実行します。

$ oc statusこのコマンドは、コンポーネントとそれらの各種の関係を含む現在のプロジェクトの概要を示します。

2.1.11. Web コンソールを使用したプロジェクトの削除

OpenShift Container Platform Web コンソールを使用してプロジェクトを削除できます。

プロジェクトを削除するパーミッションがない場合は、Delete Project オプションが選択できなくなります。

手順

- Home → Projects に移動します。

- プロジェクトの一覧から削除するプロジェクトを見つけます。

-

プロジェクトリストの右側にある Options メニュー

から Delete Project を選択します。

から Delete Project を選択します。

- Delete Project ペインが開いたら、フィールドから削除するプロジェクトの名前を入力します。

- Delete をクリックします。

2.1.12. CLI を使用したプロジェクトの削除

プロジェクトを削除する際に、サーバーはプロジェクトのステータスを Active から Terminating に更新します。次に、サーバーは Terminating 状態のプロジェクトからすべてのコンテンツをクリアしてから、最終的にプロジェクトを削除します。プロジェクトのステータスが Terminating の場合、新規のコンテンツをプロジェクトに追加することはできません。プロジェクトは CLI または Web コンソールから削除できます。

手順

以下を実行します。

$ oc delete project <project_name>

2.2. 別のユーザーとしてのプロジェクトの作成

権限の借用機能により、別のユーザーとしてプロジェクトを作成することができます。

2.2.1. API の権限借用

OpenShift Container Platform API への要求を、別のユーザーから発信されているかのように設定できます。詳細は、Kubernetes ドキュメントの User impersonation を参照してください。

2.2.2. プロジェクト作成時のユーザー権限の借用

プロジェクト要求を作成する際に別のユーザーの権限を借用できます。system:authenticated:oauth はプロジェクト要求を作成できる唯一のブートストラップグループであるため、そのグループの権限を借用する必要があります。

手順

別のユーザーの代わりにプロジェクト要求を作成するには、以下を実行します。

$ oc new-project <project> --as=<user> \ --as-group=system:authenticated --as-group=system:authenticated:oauth

2.3. プロジェクト作成の設定

OpenShift Container Platform では、プロジェクト は関連するオブジェクトをグループ分けし、分離するために使用されます。Web コンソールまたは oc new-project コマンドを使用して新規プロジェクトの作成要求が実行されると、OpenShift Container Platform のエンドポイントは、カスタマイズ可能なテンプレートに応じてプロジェクトをプロビジョニングするために使用されます。

クラスター管理者は、開発者やサービスアカウントが独自のプロジェクトを作成し、プロジェクトの セルフプロビジョニング を実行することを許可し、その方法を設定できます。

2.3.1. プロジェクト作成について

OpenShift Container Platform API サーバーは、クラスターのプロジェクト設定リソースの projectRequestTemplate パラメーターで識別されるプロジェクトテンプレートに基づいて新規プロジェクトを自動的にプロビジョニングします。パラメーターが定義されない場合、API サーバーは要求される名前でプロジェクトを作成するデフォルトテンプレートを作成し、要求するユーザーをプロジェクトの admin (管理者) ロールに割り当てます。

プロジェクト要求が送信されると、API はテンプレートで以下のパラメーターを置き換えます。

| パラメーター | 説明 |

|---|---|

|

| プロジェクトの名前。必須。 |

|

| プロジェクトの表示名。空にできます。 |

|

| プロジェクトの説明。空にできます。 |

|

| 管理ユーザーのユーザー名。 |

|

| 要求するユーザーのユーザー名。 |

API へのアクセスは、self-provisioner ロールと self-provisioners のクラスターロールバインディングで開発者に付与されます。デフォルトで、このロールはすべての認証された開発者が利用できます。

2.3.2. 新規プロジェクトのテンプレートの変更

クラスター管理者は、デフォルトのプロジェクトテンプレートを変更し、新規プロジェクトをカスタム要件に基づいて作成することができます。

独自のカスタムプロジェクトテンプレートを作成するには、以下を実行します。

手順

-

cluster-admin権限を持つユーザーとしてログインしている。 デフォルトのプロジェクトテンプレートを生成します。

$ oc adm create-bootstrap-project-template -o yaml > template.yaml-

オブジェクトを追加するか、既存オブジェクトを変更することにより、テキストエディターで生成される

template.yamlファイルを変更します。 プロジェクトテンプレートは、

openshift-confignamespace に作成される必要があります。変更したテンプレートを読み込みます。$ oc create -f template.yaml -n openshift-configWeb コンソールまたは CLI を使用し、プロジェクト設定リソースを編集します。

Web コンソールの使用

- Administration → Cluster Settings ページに移動します。

- Configuration をクリックし、すべての設定リソースを表示します。

- Project のエントリーを見つけ、Edit YAML をクリックします。

CLI の使用

project.config.openshift.io/clusterリソースを編集します。$ oc edit project.config.openshift.io/cluster

specセクションを、projectRequestTemplateおよびnameパラメーターを組み込むように更新し、アップロードされたプロジェクトテンプレートの名前を設定します。デフォルト名はproject-requestです。カスタムプロジェクトテンプレートを含むプロジェクト設定リソース

apiVersion: config.openshift.io/v1 kind: Project metadata: ... spec: projectRequestTemplate: name: <template_name>- 変更を保存した後、変更が正常に適用されたことを確認するために、新しいプロジェクトを作成します。

2.3.3. プロジェクトのセルフプロビジョニングの無効化

認証されたユーザーグループによる新規プロジェクトのセルフプロビジョニングを禁止することができます。

手順

-

cluster-admin権限を持つユーザーとしてログインしている。 以下のコマンドを実行して、

self-provisionersクラスターロールバインディングの使用を確認します。$ oc describe clusterrolebinding.rbac self-provisioners出力例

Name: self-provisioners Labels: <none> Annotations: rbac.authorization.kubernetes.io/autoupdate=true Role: Kind: ClusterRole Name: self-provisioner Subjects: Kind Name Namespace ---- ---- --------- Group system:authenticated:oauthself-provisionersセクションのサブジェクトを確認します。self-provisionerクラスターロールをグループsystem:authenticated:oauthから削除します。self-provisionersクラスターロールバインディングがself-provisionerロールのみをsystem:authenticated:oauthグループにバインドする場合、以下のコマンドを実行します。$ oc patch clusterrolebinding.rbac self-provisioners -p '{"subjects": null}'self-provisionersクラスターロールバインディングがself-provisionerロールをsystem:authenticated:oauthグループ以外のユーザー、グループまたはサービスアカウントにバインドする場合、以下のコマンドを実行します。$ oc adm policy \ remove-cluster-role-from-group self-provisioner \ system:authenticated:oauth

ロールへの自動更新を防ぐには、

self-provisionersクラスターロールバインディングを編集します。自動更新により、クラスターロールがデフォルトの状態にリセットされます。CLI を使用してロールバインディングを更新するには、以下を実行します。

以下のコマンドを実行します。

$ oc edit clusterrolebinding.rbac self-provisioners表示されるロールバインディングで、以下の例のように

rbac.authorization.kubernetes.io/autoupdateパラメーター値をfalseに設定します。apiVersion: authorization.openshift.io/v1 kind: ClusterRoleBinding metadata: annotations: rbac.authorization.kubernetes.io/autoupdate: "false" ...

単一コマンドを使用してロールバインディングを更新するには、以下を実行します。

$ oc patch clusterrolebinding.rbac self-provisioners -p '{ "metadata": { "annotations": { "rbac.authorization.kubernetes.io/autoupdate": "false" } } }'

認証されたユーザーとしてログインし、プロジェクトのセルフプロビジョニングを実行できないことを確認します。

$ oc new-project test出力例

Error from server (Forbidden): You may not request a new project via this API.組織に固有のより有用な説明を提供できるようこのプロジェクト要求メッセージをカスタマイズすることを検討します。

2.3.4. プロジェクト要求メッセージのカスタマイズ

プロジェクトのセルフプロビジョニングを実行できない開発者またはサービスアカウントが Web コンソールまたは CLI を使用してプロジェクト作成要求を行う場合、以下のエラーメッセージがデフォルトで返されます。

You may not request a new project via this API.クラスター管理者はこのメッセージをカスタマイズできます。これを、組織に固有の新規プロジェクトの要求方法の情報を含むように更新することを検討します。以下に例を示します。

-

プロジェクトを要求するには、システム管理者 (

projectname@example.com) に問い合わせてください。 -

新規プロジェクトを要求するには、

https://internal.example.com/openshift-project-requestにあるプロジェクト要求フォームに記入します。

プロジェクト要求メッセージをカスタマイズするには、以下を実行します。

手順

Web コンソールまたは CLI を使用し、プロジェクト設定リソースを編集します。

Web コンソールの使用

- Administration → Cluster Settings ページに移動します。

- Configuration をクリックし、すべての設定リソースを表示します。

- Project のエントリーを見つけ、Edit YAML をクリックします。

CLI の使用

-

cluster-admin権限を持つユーザーとしてログインしている。 project.config.openshift.io/clusterリソースを編集します。$ oc edit project.config.openshift.io/cluster

-

specセクションを、projectRequestMessageパラメーターを含むように更新し、値をカスタムメッセージに設定します。カスタムプロジェクト要求メッセージを含むプロジェクト設定リソース

apiVersion: config.openshift.io/v1 kind: Project metadata: ... spec: projectRequestMessage: <message_string>以下に例を示します。

apiVersion: config.openshift.io/v1 kind: Project metadata: ... spec: projectRequestMessage: To request a project, contact your system administrator at projectname@example.com.- 変更を保存した後に、プロジェクトをセルフプロビジョニングできない開発者またはサービスアカウントとして新規プロジェクトの作成を試行し、変更が正常に適用されていることを確認します。

第3章 アプリケーションの作成

3.1. 開発者パースペクティブを使用したアプリケーションの作成

Web コンソールの Developer パースペクティブでは、+Add ビューからアプリケーションおよび関連サービスを作成し、それらを OpenShift Container Platform にデプロイするための以下のオプションが提供されます。

リソースの使用: 開発者コンソールを使い始めるには、これらのリソースを使用します。Options メニュー

を使用してヘッダーを非表示にすることができます。

を使用してヘッダーを非表示にすることができます。

- サンプルを使用したアプリケーションの作成: 既存のコードサンプルを使用して、OpenShift Container Platform でアプリケーションの作成を開始します。

- ガイド付きドキュメントを使用してビルド: ガイド付きドキュメントを参照してアプリケーションを構築し、主なコンセプトや用語に慣れてください。

- 新規開発者機能の確認: Developer パースペクティブの新機能およびリソースを紹介します。

Developer catalog: Developer Catalog で、イメージビルダーに必要なアプリケーション、サービス、またはソースを選択し、プロジェクトに追加します。

- All Services: カタログを参照し、OpenShift Container Platform 全体でサービスを検出します。

- Database: 必要なデータベースサービスを選択し、アプリケーションに追加します。

- Operator Backed: 必要な Operator 管理サービスを選択し、デプロイします。

- Helm Chart: 必要な Helm チャートを選択し、アプリケーションおよびサービスのデプロイメントを単純化します。

- Devfile: Devfile レジストリーから devfile を選択して、開発環境を宣言的に定義します。

Event Source: 特定のシステムからイベントソースを選択し、関心のあるイベントクラスを登録します。

注記RHOAS Operator がインストールされている場合には、マネージドサービスオプションも利用できます。

- Git repository: From Git、From Devfile または From Dockerfile オプションを使用して Git リポジトリーから既存のコードベース、Devfile、または Dockerfile をインポートし、OpenShift Container Platform でアプリケーションをビルドしてデプロイします。

- Container Image: イメージストリームまたはレジストリーからの既存イメージを使用し、これを OpenShift Container Platform にデプロイします。

- Pipelines: Tekton パイプラインを使用して OpenShift Container Platform でソフトウェア配信プロセスの CI/CD パイプラインを作成します。

Serverless: Serverless オプションを検査して、OpenShift Container Platform でステートレスおよびサーバーレスアプリケーションを作成、ビルド、デプロイします。

- Channel: Knative チャネルを作成し、インメモリーの信頼性の高い実装を備えたイベント転送および永続化層を作成します。

- Samples: 利用可能なサンプルアプリケーションを確認して、アプリケーションをすばやく作成、ビルド、デプロイします。

- Quick Starts: アプリケーションを作成、インポート、および実行するためのクイックスタートオプションを調べて、ステップバイステップの手順とタスクを使用します。

From Local Machine: From Local Machine タイルを確認して、ローカルマシンのファイルをインポートまたはアップロードし、簡単にアプリケーションをビルドしてデプロイします。

- Import YAML: YAML ファイルをアップロードし、アプリケーションをビルドしてデプロイするためのリソースを定義します。

- Upload JAR file: JAR ファイルをアップロードして Java アプリケーションをビルドおよびデプロイします。

- Share my Project: このオプションを使用して、プロジェクトにユーザーを追加または削除し、アクセシビリティオプションを提供します。

- Helm Chart リポジトリー: このオプションを使用して、namespace に Helm Chart リポジトリーを追加します。

- リソースの並べ替え: これらのリソースを使用して、ナビゲーションペインに追加済みのピン留めされたリソースを並べ替えます。ナビゲーションウィンドウでピン留めされたリソースにカーソルを合わせると、その左側にドラッグアンドドロップアイコンが表示されます。ドラッグしたリソースは、それが属するセクションにのみドロップできます。

Pipelines、Event Source、Import Virtual Machines などの特定のオプションは、OpenShift Pipelines Operator、OpenShift Serverless Operator、および OpenShift Virtualization Operator がインストールされる場合にのみそれぞれ表示されることに注意してください。

3.1.1. 前提条件

Developer パースペクティブを使用してアプリケーションを作成するには、以下を確認してください。

- Web コンソールにログインしている。

- OpenShift Container Platform でアプリケーションおよび他のワークロードを作成するために、プロジェクトを作成しているか、適切な ロールおよびパーミッション を持つプロジェクトにアクセスできる。

前述の前提条件に加えてサーバーレスアプリケーションを作成するには、以下を確認します。

3.1.2. サンプルアプリケーションの作成

Developer パースペクティブの +Add フローでサンプルアプリケーションを使用し、アプリケーションをすぐに作成し、ビルドし、デプロイできます。

前提条件

- OpenShift Container Platform Web コンソールにログインしており、Developer パースペクティブにいます。

手順

- +Add ビューで、Samples タイルをクリックし、Samples ページを表示します。

- Samples ページで、利用可能なサンプルアプリケーションの 1 つを選択し、Create Sample Application フォームを表示します。

Create Sample Application Form:

- Name フィールドには、デフォルトでデプロイメント名が表示されます。この名前は必要に応じて変更することができます。

- Builder Image Version では、ビルダーイメージがデフォルトで選択されます。Builder Image Version ドロップダウンリストを使用してイメージバージョンを変更できます。

- Git リポジトリー URL のサンプルは、デフォルトで追加されます。

- Create をクリックしてサンプルアプリケーションを作成します。サンプルアプリケーションのビルドステータスが Topology ビューに表示されます。サンプルアプリケーションの作成後、デプロイメントがアプリケーションに追加されていることを確認できます。

3.1.3. クイックスタートを使用したアプリケーションの作成

Quick Starts ページでは、OpenShift Container Platform でアプリケーションを作成、インポート、および実行する方法を、段階的な手順とタスクとともに示します。

前提条件

- OpenShift Container Platform Web コンソールにログインしており、Developer パースペクティブにいます。

手順

- +Add ビューで、View all quick starts リンクをクリックして、クイックスタート ページを表示します。

- Quick Starts ページで、使用するクイックスタートのタイルをクリックします。

- Start をクリックして、クイックスタートを開始します。

3.1.4. Git のコードベースのインポートおよびアプリケーションの作成

Developer パースペクティブを使用し、GitHub で既存のコードベースを使用して OpenShift Container Platform でアプリケーションを作成し、ビルドし、デプロイすることができます。

以下の手順では、Developer パースペクティブの From Git オプションを使用してアプリケーションを作成します。

手順

- +Add ビューで、Git Repository タイルの From Git をクリックし、Import from git フォームを表示します。

-

Git セクションで、アプリケーションの作成に使用するコードベースの Git リポジトリー URL を入力します。たとえば、このサンプル nodejs アプリケーションの URL

https://github.com/sclorg/nodejs-exを入力します。その後、URL は検証されます。 オプション: Show Advanced Git Options をクリックし、以下のような詳細を追加できます。

- Git Reference: アプリケーションのビルドに使用する特定のブランチ、タグ、またはコミットのコードを参照します。

- Context Dir: アプリケーションのビルドに使用するアプリケーションのソースコードのサブディレクトリーを指定します。

- Source Secret: プライベートリポジトリーからソースコードをプルするための認証情報で Secret Name を作成します。

オプション: Git リポジトリーを使用して devfile、Dockerfile、またはビルダーイメージをインポートして、デプロイメントをさらにカスタマイズできるようになりました。

- Git リポジトリーに devfile、Dockerfile、またはビルダーイメージが含まれる場合には、これらは自動的に検出され、それぞれのパスフィールドに設定されます。devfile、Dockerfile、およびビルダーイメージが同じリポジトリーで検出されると、devfile はデフォルトで選択されます。

- ファイルのインポートタイプを編集して、別のストラテジーを選択し、Edit import strategy オプションをクリックします。

- 複数の devfile、Dockerfile、またはビルダーイメージを検出された場合に、特定の devfile、Dockerfile、またはビルダーイメージをインポートするにはコンテキストディレクトリーを起点とした相対パスを指定します。

Git URL の検証後に、推奨されるビルダーイメージが選択されて星マークが付けられます。ビルダーイメージが自動検出されていない場合は、ビルダーイメージを選択します。

https://github.com/sclorg/nodejs-exGit URL の場合、Node.js ビルダーイメージがデフォルトで選択されます。- オプション:Builder Image Version ドロップダウンリストを使用してバージョンを指定します。

- オプション:Edit import strategy を使用して、別のストラテジーを選択します。

- オプション:Node.js ビルダーイメージの場合、Run command フィールドを使用して、アプリケーションを実行するためにコマンドを上書きします。

General セクションで、以下を実行します。

-

Application フィールドに、アプリケーションを分類するために一意の名前 (

myappなど) を入力します。アプリケーション名が namespace で一意であることを確認します。 Name フィールドで、既存のアプリケーションが存在しない場合に、このアプリケーション用に作成されたリソースが Git リポジトリー URL をベースとして自動的に設定されることを確認します。既存のアプリケーションがある場合には、既存のアプリケーション内でそのコンポーネントをデプロイしたり、新しいアプリケーションを作成したり、またはコンポーネントをいずれにも割り当てない状態にしたりすることができます。

注記リソース名は namespace で一意である必要があります。エラーが出る場合はリソース名を変更します。

-

Application フィールドに、アプリケーションを分類するために一意の名前 (

Resources セクションで、以下を選択します。

- Deployment: 単純な Kubernetes スタイルのアプリケーションを作成します。

- Deployment Config: OpenShift Container Platform スタイルのアプリケーションを作成します。

Serverless Deployment: Knative サービスを作成します。

注記Serverless Deployment オプションは、Serverless Operator がクラスターにインストールされている場合にのみ、Import from git フォームに表示されます。詳細は、OpenShift Serverless のドキュメントを参照してください。

- Pipelines セクションで、 Add Pipeline を選択してから Show Pipeline Visualization をクリックし、アプリケーションのパイプラインを表示します。デフォルトのパイプラインが選択されますが、アプリケーションで利用可能なパイプラインのリストから必要なパイプラインを選択できます。

オプション: Advanced Options セクションでは、Target port および Create a route to the application がデフォルトで選択されるため、公開されている URL を使用してアプリケーションにアクセスできます。

アプリケーションがデフォルトのパブリックポート 80 でデータを公開しない場合は、チェックボックスの選択を解除し、公開する必要のあるターゲットポート番号を設定します。

- オプション: 以下の高度なオプションを使用してアプリケーションをさらにカスタマイズできます。

- Routing

Routing のリンクをクリックして、以下のアクションを実行できます。

- ルートのホスト名をカスタマイズします。

- ルーターが監視するパスを指定します。

- ドロップダウンリストから、トラフィックのターゲットポートを選択します。

Secure Route チェックボックスを選択してルートを保護します。必要な TLS 終端タイプを選択し、各ドロップダウンリストから非セキュアなトラフィックについてのポリシーを設定します。

注記サーバーレスアプリケーションの場合、Knative サービスが上記のすべてのルーティングオプションを管理します。ただし、必要に応じて、トラフィックのターゲットポートをカスタマイズできます。ターゲットポートが指定されていない場合、デフォルトポートの

8080が使用されます。

- ドメインマッピング

Serverless Deployment を作成する場合、作成時に Knative サービスにカスタムドメインマッピングを追加できます。

Advanced options セクションで、Show advanced Routing options をクリックします。

- サービスにマッピングするドメインマッピング CR がすでに存在する場合は、Domain mapping のドロップダウンメニューから選択できます。

-

新規ドメインマッピング CR を作成する場合は、ドメイン名をボックスに入力し、Create オプションを選択します。たとえば、

example.comと入力すると、Create オプションは Create "example.com" になります。

- ヘルスチェック

Health Checks リンクをクリックして、Readiness、Liveness、および Startup プローブをアプリケーションに追加します。すべてのプローブに事前に設定されたデフォルトデータが実装され、必要に応じてデフォルトデータでプローブを追加したり、必要に応じてこれをカスタマイズしたりできます。

ヘルスプローブをカスタマイズするには、以下を実行します。

- Add Readiness Probe をクリックし、必要に応じてコンテナーが要求を処理する準備ができているかどうかを確認するためにパラメーターを変更し、チェックマークを選択してプローブを追加します。

- Add Liveness Probe をクリックし、必要に応じてコンテナーが実行中かどうかを確認するためにパラメーターを変更し、チェックマークを選択してプローブを追加します。

Add Startup Probe をクリックし、必要に応じてコンテナー内のアプリケーションが起動しているかどうかを確認するためにパラメーターを変更し、チェックマークを選択してプローブを追加します。

それぞれのプローブについて、ドロップダウンリストから要求タイプ (HTTP GET、Container Command、TCP Socket) を指定できます。選択した要求タイプに応じてフォームが変更されます。次に、プローブの成功および失敗のしきい値、コンテナーの起動後の最初のプローブ実行までの秒数、プローブの頻度、タイムアウト値など、他のパラメーターのデフォルト値を変更できます。

- ビルド設定およびデプロイメント

Build Configuration および Deployment リンクをクリックして、それぞれの設定オプションを表示します。オプションの一部はデフォルトで選択されています。必要なトリガーおよび環境変数を追加して、オプションをさらにカスタマイズできます。

サーバーレスアプリケーションの場合、Deployment オプションは表示されません。これは、Knative 設定リソースが

DeploymentConfigリソースの代わりにデプロイメントの必要な状態を維持するためです。

- スケーリング

Scaling リンクをクリックして、最初にデプロイするアプリケーションの Pod 数またはインスタンス数を定義します。

サーバーレスデプロイメントを作成する場合、以下の設定を行うこともできます。

-

Min Pods は、Knative サービスである時点で実行する必要がある Pod 数の下限を決定します。これは、

minScale設定としても知られています。 -

Max Pods は、Knative サービスである時点で実行できる Pod 数の上限を決定します。これは、

maxScale設定としても知られています。 - Concurrency target は、ある時点でアプリケーションの各インスタンスに対して必要な同時リクエストの数を決定します。

- Concurrency limit は、ある時点でアプリケーションの各インスタンスに対して許容される同時リクエストの数の制限を決定します。

- Concurrency utilization は、Knative が追加のトラフィックを処理するために追加の Pod をスケールアップする際に満たす必要のある同時リクエストの制限のパーセンテージを決定します。

-

Autoscale window は、Autoscaler がパニックモードではない場合に、スケーリングの決定を行う際のインプットを提供するためにメトリクスの平均値を計算する期間を定義します。この期間中にリクエストが受信されなかった場合、サービスはゼロにスケーリングされます。Autoscale window のデフォルト期間は

60sです。これは stable window としても知られています。

-

Min Pods は、Knative サービスである時点で実行する必要がある Pod 数の下限を決定します。これは、

- リソースの制限

- Resource Limit リンクをクリックして、コンテナーが実行時に保証または使用が許可されている CPU および メモリー リソースの量を設定します。

- ラベル

Labels リンクをクリックして、カスタムラベルをアプリケーションに追加します。

- Create をクリックしてアプリケーションを作成し、成功の通知が表示されます。Topology ビューでアプリケーションのビルドステータスを確認できます。

3.1.5. JAR ファイルをアップロードして Java アプリケーションをデプロイする

Web コンソールの Developer パースペクティブで、以下のオプションを使用して JAR ファイルをアップロードできます。

- Developer パースペクティブの +Add ビューに移動し、From Local Machine タイルで Upload JAR file をクリックします。JAR ファイルを参照および選択するか、JAR ファイルをドラッグしてアプリケーションをデプロイします。

- Topology ビューに移動し、Upload JAR file オプションを使用するか、JAR ファイルをドラッグしてアプリケーションをデプロイします。

- Topology ビューのコンテキストメニューで Upload JAR file オプションを使用して JAR ファイルをアップロードしてアプリケーションをデプロイします。

前提条件

- クラスター管理者が Cluster Samples Operator をインストールしている。

- OpenShift Container Platform Web コンソールにアクセスでき、Developer パースペクティブを使用している。

手順

- Topology ビューで、任意の場所を右クリックして Add to Project メニューを表示します。

- Add to Project メニューにカーソルを置いてメニューオプションを表示し、Upload JAR file オプションを選択して Upload JAR file フォームを確認します。または、JAR ファイルを Topology ビューにドラッグできます。

- JAR file フィールドで、ローカルマシンで必要な JAR ファイルを参照し、これをアップロードします。または、JAR ファイルを フィールドにドラッグできます。互換性のないタイプのファイルが Topology ビューにドラッグされると、トーストアラートが右側に表示されます。互換性のないファイルタイプがアップロードフォームのフィールドにドロップされると、フィールドエラーが表示されます。

- デフォルトで、ランタイムアイコンとビルダーイメージが選択されています。ビルダーイメージが自動検出されていない場合は、ビルダーイメージを選択します。必要に応じて、Builder Image Version のドロップダウンリストを使用してバージョンを変更できます。

- オプション: Application Name フィールドに、リソースのラベル付けに使用する一意のアプリケーション名を入力します。

- Name フィールドに、関連付けられたリソースに名前を付けるために一意のコンポーネント名を入力します。

- Resources フィールドで、アプリケーションのリソースタイプを選択します。

- Advanced options メニューで Create a Route to the Application をクリックし、デプロイされたアプリケーションのパブリック URL を設定します。

- Create をクリックしてアプリケーションをデプロイします。JAR ファイルがアップロードされたことを通知するトースト通知が表示されます。トースト通知には、ビルドログを表示するリンクも含まれます。

ビルドの実行中にブラウザータブを閉じようとすると、Web アラートが表示されます。

JAR ファイルのアップロードとアプリケーションのデプロイメントが完了すると、Topology ビューにアプリケーションが表示されます。

3.1.6. Devfile レジストリーを使用した devfile へのアクセス

Developer パースペクティブの +Add フローで devfile を使用して、アプリケーションを作成できます。+Add フローは、devfile コミュニティーレジストリー との完全なインテグレーションを提供します。devfile は、ゼロから設定せずに開発環境を記述できる移植可能な YAML ファイルです。Devfile レジストリー を使用すると、事前に設定された devfile を使用してアプリケーションを作成できます。

手順

- Developer Perspective → +Add → Developer Catalog → All Services に移動します。Developer Catalog で利用可能なすべてのサービスの一覧が表示されます。

- All Services セクションで Devfiles を選択し、特定の言語またはフレームワークをサポートする devfile を参照します。あるいは、キーワードフィルターを使用して、名前、タグ、または説明を使用して特定の devfile を検索できます。

- アプリケーションの作成に使用する devfile をクリックします。devfile タイルに、devfile の名前、説明、プロバイダー、および ドキュメントなど、devfile の詳細が表示されます。

- Create をクリックしてアプリケーションを作成し、Topology ビューでアプリケーションを表示します。

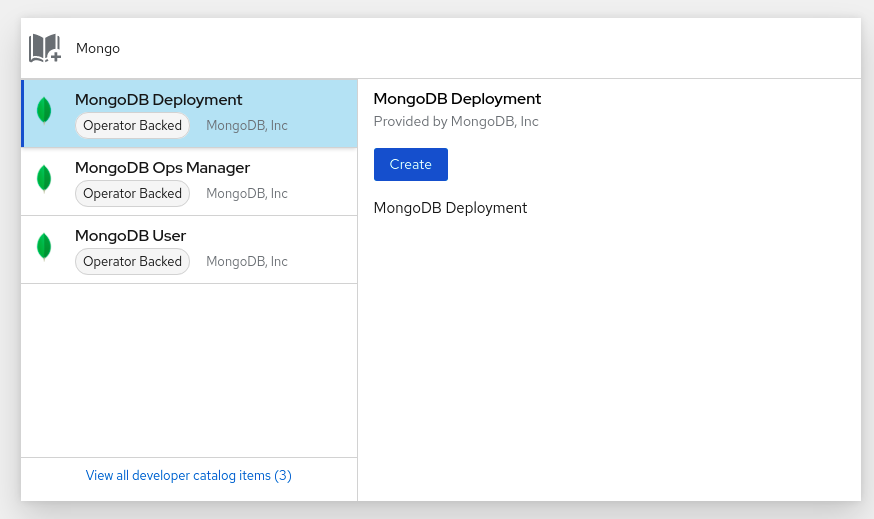

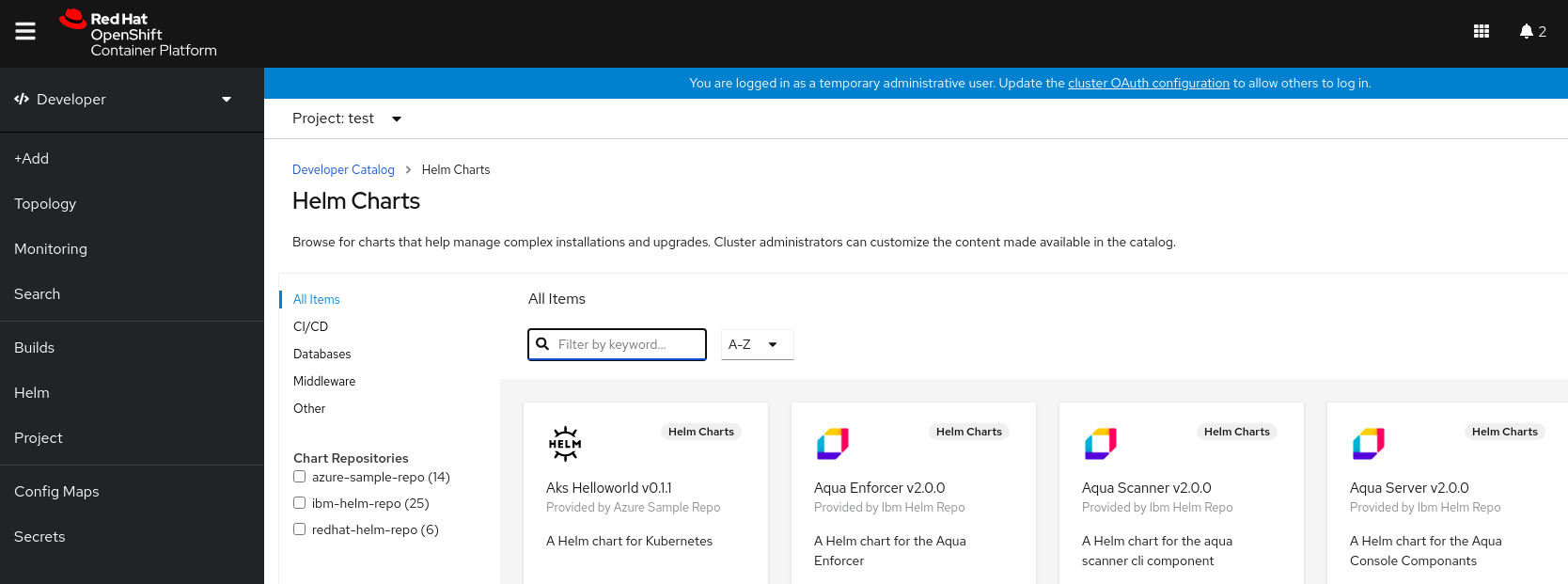

3.1.7. Developer Catalog を使用したサービスまたはコンポーネントのアプリケーションへの追加

Developer Catalog を使用して、データベース、ビルダーイメージ、Helm チャートなどの Operator がサポートするサービスに基づいてアプリケーションとサービスをデプロイします。Developer Catalog には、プロジェクトに追加できるアプリケーションコンポーネント、サービス、イベントソース、または Source-to-Image ビルダーのコレクションが含まれます。クラスター管理者は、カタログで利用可能なコンテンツをカスタマイズできます。

手順

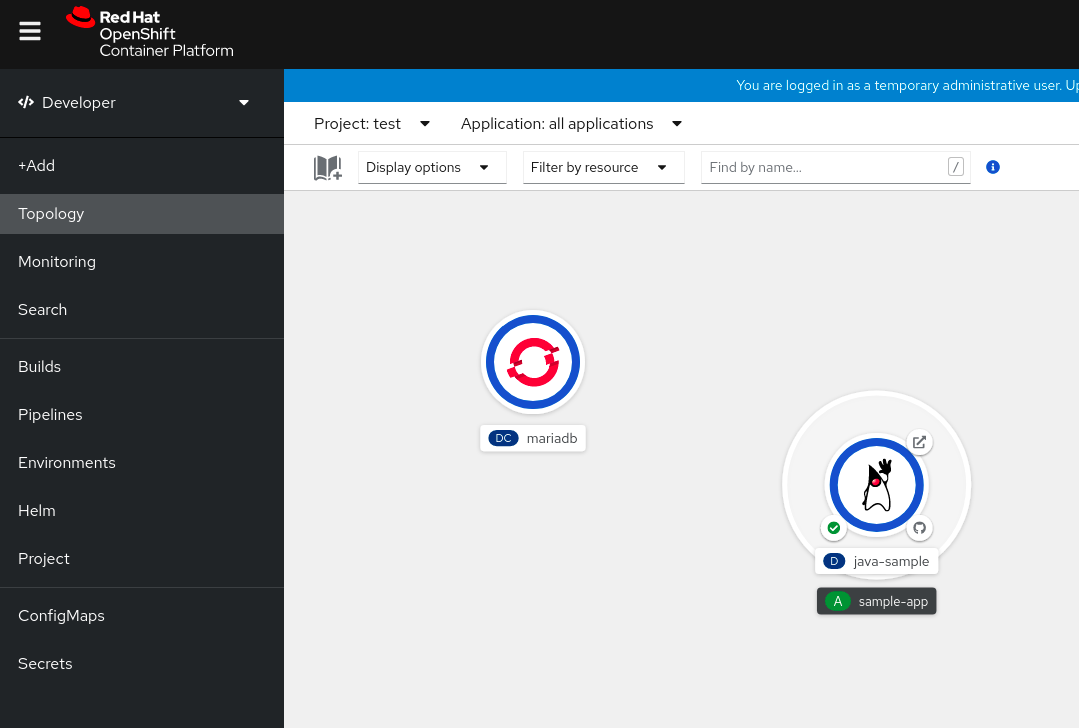

- Developer パースペクティブで、+Add に移動して、Developer Catalog タイルから All Services をクリックし、Developer Catalog で利用可能なすべてのサービスを表示します。

- All Services で、サービスの種類またはプロジェクトに追加する必要のあるコンポーネントを選択します。この例では、Databases を選択してすべてのデータベースサービスを一覧表示し、MariaDB をクリックしてサービスの詳細を表示します。

Instantiate Template をクリックして、MariaDB サービスの詳細情報を含む自動的に設定されたテンプレートを表示し、Create をクリックして Topology ビューで MariaDB サービスを作成し、これを表示します。

図3.1 トポロジーの MariaDB

3.2. インストールされた Operator からのアプリケーションの作成

Operator は、Kubernetes アプリケーションをパッケージ化し、デプロイし、管理する方法です。クラスター管理者によってインストールされる Operator を使用して、アプリケーションを OpenShift Container Platform で作成できます。

以下では、開発者を対象に、OpenShift Container Platform Web コンソールを使用して、インストールされた Operator からアプリケーションを作成する例を示します。

3.2.1. Operator を使用した etcd クラスターの作成

この手順では、Operator Lifecycle Manager (OLM) で管理される etcd Operator を使用した新規 etcd クラスターの作成について説明します。

前提条件

- OpenShift Container Platform 4.11 クラスターにアクセスできる

- 管理者によってクラスター全体に etcd Operator がすでにインストールされている。

手順

-

この手順を実行するために OpenShift Container Platform Web コンソールで新規プロジェクトを作成します。この例では、

my-etcdというプロジェクトを使用します。 Operators → Installed Operators ページに移動します。クラスター管理者によってクラスターにインストールされ、使用可能にされた Operator がクラスターサービスバージョン (CSV) のリストとしてここに表示されます。CSV は Operator によって提供されるソフトウェアを起動し、管理するために使用されます。

ヒント以下を使用して、CLI でこのリストを取得できます。

$ oc get csvInstalled Operators ページで、etcd Operator をクリックして詳細情報および選択可能なアクションを表示します。

Provided APIs に表示されているように、この Operator は 3 つの新規リソースタイプを利用可能にします。これには、etcd クラスター (

EtcdClusterリソース) のタイプが含まれます。これらのオブジェクトは、DeploymentまたはReplicaSetなどの組み込み済みのネイティブ Kubernetes オブジェクトと同様に機能しますが、これらには etcd を管理するための固有のロジックが含まれます。新規 etcd クラスターを作成します。

- etcd Cluster API ボックスで、Create instance をクリックします。

-

次の画面では、クラスターのサイズなど

EtcdClusterオブジェクトのテンプレートを起動する最小条件への変更を加えることができます。ここでは Create をクリックして確定します。これにより、Operator がトリガーされ、Pod、サービス、および新規 etcd クラスターの他のコンポーネントが起動します。

example etcd クラスターをクリックしてから Resources タブをクリックして、プロジェクトに Operator によって自動的に作成され、設定された数多くのリソースが含まれることを確認します。

Kubernetes サービスが作成され、プロジェクトの他の Pod からデータベースにアクセスできることを確認します。

所定プロジェクトで

editロールを持つすべてのユーザーは、クラウドサービスのようにセルフサービス方式でプロジェクトにすでに作成されている Operator によって管理されるアプリケーションのインスタンス (この例では etcd クラスター) を作成し、管理し、削除することができます。この機能を持つ追加のユーザーを有効にする必要がある場合、プロジェクト管理者は以下のコマンドを使用してこのロールを追加できます。$ oc policy add-role-to-user edit <user> -n <target_project>

これで、etcd クラスターは Pod が正常でなくなったり、クラスターのノード間で移行する際の障害に対応し、データのリバランスを行います。最も重要な点として、適切なアクセスを持つクラスター管理者または開発者は独自のアプリケーションでデータベースを簡単に使用できるようになります。

3.3. CLI を使用したアプリケーションの作成

OpenShift Container Platform CLI を使用して、ソースまたはバイナリーコード、イメージおよびテンプレートを含むコンポーネントから OpenShift Container Platform アプリケーションを作成できます。

new-app で作成したオブジェクトのセットは、ソースリポジトリー、イメージまたはテンプレートなどのインプットとして渡されるアーティファクトによって異なります。

3.3.1. ソースコードからのアプリケーションの作成

new-app コマンドを使用して、ローカルまたはリモート Git リポジトリーのソースコードからアプリケーションを作成できます。

new-app コマンドは、ビルド設定を作成し、これはソースコードから新規のアプリケーションイメージを作成します。new-app コマンドは通常、Deployment オブジェクトを作成して新規のイメージをデプロイするほか、サービスを作成してイメージを実行するデプロイメントへの負荷分散したアクセスを提供します。

OpenShift Container Platform は、パイプライン、ソース、または docker ビルドストラテジーのいずれを使用すべきかを自動的に検出します。また、ソースビルドの場合は、適切な言語のビルダーイメージを検出します。

3.3.1.1. Local

ローカルディレクトリーの Git リポジトリーを使用してアプリケーションを作成するには、以下を実行します。

$ oc new-app /<path to source code>

ローカル Git リポジトリーを使用する場合には、リポジトリーで OpenShift Container Platform クラスターがアクセス可能な URL を参照する origin という名前のリモートリポジトリーが必要です。認識されているリモートがない場合は、new-app コマンドを実行してバイナリービルドを作成します。

3.3.1.2. リモート

リモート Git リポジトリーを使用してアプリケーションを作成するには、以下を実行します。

$ oc new-app https://github.com/sclorg/cakephp-exプライベートのリモート Git リポジトリーを使用してアプリケーションを作成するには、以下を実行します。

$ oc new-app https://github.com/youruser/yourprivaterepo --source-secret=yoursecret

プライベートリモート Git リポジトリーを使用する場合には、--source-secret フラグを使用して、既存のソースクローンのシークレットを指定できます。このシークレットは、ビルド設定に挿入され、リポジトリーにアクセスできるようになります。

--context-dir フラグを指定することで、ソースコードリポジトリーのサブディレクトリーを使用できます。リモート Git リポジトリーおよびコンテキストサブディレクトリーを使用してアプリケーションを作成する場合は、以下を実行します。

$ oc new-app https://github.com/sclorg/s2i-ruby-container.git \

--context-dir=2.0/test/puma-test-app

また、リモート URL を指定する場合は、以下のように URL の最後に #<branch_name> を追加することで、使用する Git ブランチを指定できます。

$ oc new-app https://github.com/openshift/ruby-hello-world.git#beta43.3.1.3. ビルドストラテジーの検出

OpenShift Container Platform は、特定のファイルを検出し、使用するビルドストラテジーを自動的に判別します。

新規アプリケーションの作成時に Jenkinsfile がソースリポジトリーのルート または指定されたコンテキストディレクトリーに存在する場合に、OpenShift Container Platform はパイプラインビルドストラテジーを生成します。

注記pipelineビルドストラテジーは非推奨になりました。代わりに Red Hat OpenShift Pipelines を使用することを検討してください。- 新規アプリケーションの作成時に Dockerfile がソースリポジトリーのルートまたは指定されたコンテキストディレクトリーに存在する場合に、OpenShift Container Platform は docker ビルドストラテジーを生成します。

- Jenkins ファイルも Dockerfile も検出されない場合、OpenShift Container Platform はソースビルドストラテジーを生成します。

--strategy フラグを docker、pipeline、または source に設定して、自動的に検出されたビルドストラテジーを上書きします。

$ oc new-app /home/user/code/myapp --strategy=docker

oc コマンドを使用するには、ビルドソースを含むファイルがリモートの git リポジトリーで利用可能である必要があります。すべてのソースビルドには、git remote -v を使用する必要があります。

3.3.1.4. 言語の検出

ソースビルドストラテジーを使用する場合に、new-app はリポジトリーのルート または指定したコンテキストディレクトリーに特定のファイルが存在するかどうかで、使用する言語ビルダーを判別しようとします。

| 言語 | ファイル |

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

言語の検出後、new-app は OpenShift Container Platform サーバーで、検出言語と一致して supports アノテーションが指定されたイメージストリームタグか、検出された言語の名前に一致するイメージストリームの有無を検索します。一致するものが見つからない場合には、new-app は Docker Hub レジストリー で名前をベースにした検出言語と一致するイメージの検索を行います。

~ をセパレーターとして使用し、イメージ (イメージストリームまたはコンテナーの仕様) とリポジトリーを指定して、ビルダーが特定のソースリポジトリーを使用するようにイメージを上書きすることができます。この方法を使用すると、ビルドストラテジーの検出および言語の検出は実行されない点に留意してください。

たとえば、リモートリポジトリーのソースを使用して myproject/my-ruby イメージストリームを作成する場合は、以下を実行します。

$ oc new-app myproject/my-ruby~https://github.com/openshift/ruby-hello-world.git

ローカルリポジトリーのソースを使用して openshift/ruby-20-centos7:latest コンテナーのイメージストリームを作成するには、以下を実行します。

$ oc new-app openshift/ruby-20-centos7:latest~/home/user/code/my-ruby-app

言語の検出では、リポジトリーのクローンを作成し、検査できるように Git クライアントをローカルにインストールする必要があります。Git が使用できない場合、<image>~<repository> 構文を指定し、リポジトリーで使用するビルダーイメージを指定して言語の検出手順を回避することができます。

-i <image> <repository> 呼び出しでは、アーティファクトのタイプを判別するために new-app が repository のクローンを試行する必要があります。そのため、これは Git が利用できない場合には失敗します。

-i <image> --code <repository> 呼び出しでは、image がソースコードのビルダーとして使用されるか、データベースイメージの場合のように別個にデプロイされる必要があるかどうかを判別するために、new-app が repository のクローンを作成する必要があります。

3.3.2. イメージからアプリケーションを作成する方法

既存のイメージからアプリケーションのデプロイが可能です。イメージは、OpenShift Container Platform サーバー内のイメージストリーム、指定したレジストリー内のイメージ、またはローカルの Docker サーバー内のイメージから取得できます。

new-app コマンドは、渡された引数に指定されたイメージの種類を判断しようとします。ただし、イメージが、--docker-image 引数を使用したコンテナーイメージなのか、-i|--image-stream 引数を使用したイメージストリームなのかを、new-app に明示的に指示できます。

ローカル Docker リポジトリーからイメージを指定した場合、同じイメージが OpenShift Container Platform のクラスターノードでも利用できることを確認する必要があります。

3.3.2.1. Docker Hub MySQL イメージ

たとえば、Docker Hub MySQL イメージからアプリケーションを作成するには、以下を実行します。

$ oc new-app mysql3.3.2.2. プライベートレジストリーのイメージ

プライベートのレジストリーのイメージを使用してアプリケーションを作成し、コンテナーイメージの仕様全体を以下のように指定します。

$ oc new-app myregistry:5000/example/myimage3.3.2.3. 既存のイメージストリームおよびオプションのイメージストリームタグ

既存のイメージストリームおよび任意のイメージストリームタグでアプリケーションを作成します。

$ oc new-app my-stream:v13.3.3. テンプレートからのアプリケーションの作成

テンプレート名を引数として指定することで、事前に保存したテンプレートまたはテンプレートファイルからアプリケーションを作成することができます。たとえば、サンプルアプリケーションテンプレートを保存し、これを利用してアプリケーションを作成できます。

現在のプロジェクトのテンプレートライブラリーにアプリケーションテンプレートをアップロードします。以下の例では、examples/sample-app/application-template-stibuild.json というファイルからアプリケーションテンプレートをアップロードします。

$ oc create -f examples/sample-app/application-template-stibuild.json

次に、アプリケーションテンプレートを参照して新規アプリケーションを作成します。この例では、テンプレート名は ruby-helloworld-sample です。

$ oc new-app ruby-helloworld-sample

OpenShift Container Platform にテンプレートファイルを保存せずに、ローカルファイルシステムでテンプレートファイルを参照して新規アプリケーションを作成するには、-f|--file 引数を使用します。以下に例を示します。

$ oc new-app -f examples/sample-app/application-template-stibuild.json3.3.3.1. テンプレートパラメーター

テンプレートをベースとするアプリケーションを作成する場合、以下の -p|--param 引数を使用してテンプレートで定義したパラメーター値を設定します。

$ oc new-app ruby-helloworld-sample \

-p ADMIN_USERNAME=admin -p ADMIN_PASSWORD=mypassword

パラメーターをファイルに保存しておいて、--param-file を指定して、テンプレートをインスタンス化する時にこのファイルを使用することができます。標準入力からパラメーターを読み込む必要がある場合は、以下のように --param-file=- を使用します。以下は、helloworld.params というファイルの例です。

ADMIN_USERNAME=admin

ADMIN_PASSWORD=mypasswordテンプレートをインスタンス化する時に、ファイルのパラメーターを参照します。

$ oc new-app ruby-helloworld-sample --param-file=helloworld.params3.3.4. アプリケーション作成の変更

new-app コマンドは、OpenShift Container Platform オブジェクトを生成します。このオブジェクトにより、作成されるアプリケーションがビルドされ、デプロイされ、実行されます。通常、これらのオブジェクトは現在のプロジェクトに作成され、これらのオブジェクトには入力ソースリポジトリーまたはインプットイメージから派生する名前が割り当てられます。ただし、new-app でこの動作を変更することができます。

| オブジェクト | 説明 |

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

| その他 | テンプレートのインスタンスを作成する際に、他のオブジェクトをテンプレートに基づいて生成できます。 |

3.3.4.1. 環境変数の指定

テンプレート、ソースまたはイメージからアプリケーションを生成する場合、-e|--env 引数を使用し、ランタイムに環境変数をアプリケーションコンテナーに渡すことができます。

$ oc new-app openshift/postgresql-92-centos7 \

-e POSTGRESQL_USER=user \

-e POSTGRESQL_DATABASE=db \

-e POSTGRESQL_PASSWORD=password

変数は、--env-file 引数を使用してファイルから読み取ることもできます。以下は、postgresql.env というファイルの例です。

POSTGRESQL_USER=user

POSTGRESQL_DATABASE=db

POSTGRESQL_PASSWORD=passwordファイルから変数を読み取ります。

$ oc new-app openshift/postgresql-92-centos7 --env-file=postgresql.env

さらに --env-file=- を使用することで、標準入力で環境変数を指定することもできます。

$ cat postgresql.env | oc new-app openshift/postgresql-92-centos7 --env-file=-

-e|--env または --env-file 引数で渡される環境変数では、new-app 処理の一環として作成される BuildConfig オブジェクトは更新されません。

3.3.4.2. ビルド環境変数の指定

テンプレート、ソースまたはイメージからアプリケーションを生成する場合、--build-env 引数を使用し、ランタイムに環境変数をビルドコンテナーに渡すことができます。

$ oc new-app openshift/ruby-23-centos7 \

--build-env HTTP_PROXY=http://myproxy.net:1337/ \

--build-env GEM_HOME=~/.gem

変数は、--build-env-file 引数を使用してファイルから読み取ることもできます。以下は、ruby.env というファイルの例です。

HTTP_PROXY=http://myproxy.net:1337/

GEM_HOME=~/.gemファイルから変数を読み取ります。

$ oc new-app openshift/ruby-23-centos7 --build-env-file=ruby.env

さらに --build-env-file=- を使用して、環境変数を標準入力で指定することもできます。

$ cat ruby.env | oc new-app openshift/ruby-23-centos7 --build-env-file=-3.3.4.3. ラベルの指定

ソース、イメージ、またはテンプレートからアプリケーションを生成する場合、-l|--label 引数を使用し、作成されたオブジェクトにラベルを追加できます。ラベルを使用すると、アプリケーションに関連するオブジェクトを一括で選択、設定、削除することが簡単になります。

$ oc new-app https://github.com/openshift/ruby-hello-world -l name=hello-world3.3.4.4. 作成前の出力の表示

new-app コマンドの実行に関するドライランを確認するには、yaml または json の値と共に -o|--output 引数を使用できます。次にこの出力を使用して、作成されるオブジェクトのプレビューまたは編集可能なファイルへのリダイレクトを実行できます。問題がなければ、oc create を使用して OpenShift Container Platform オブジェクトを作成できます。

new-app アーティファクトをファイルに出力するには、以下を実行します。

$ oc new-app https://github.com/openshift/ruby-hello-world \

-o yaml > myapp.yamlファイルを編集します。

$ vi myapp.yamlファイルを参照して新規アプリケーションを作成します。

$ oc create -f myapp.yaml3.3.4.5. 別名でのオブジェクトの作成

通常 new-app で作成されるオブジェクトの名前はソースリポジトリーまたは生成に使用されたイメージに基づいて付けられます。コマンドに --name フラグを追加することで、生成されたオブジェクトの名前を設定できます。

$ oc new-app https://github.com/openshift/ruby-hello-world --name=myapp3.3.4.6. 別のプロジェクトでのオブジェクトの作成

通常 new-app は現在のプロジェクトにオブジェクトを作成します。ただし、-n|--namespace 引数を使用して、別のプロジェクトにオブジェクトを作成することができます。

$ oc new-app https://github.com/openshift/ruby-hello-world -n myproject3.3.4.7. 複数のオブジェクトの作成

new-app コマンドは、複数のパラメーターを new-app に指定して複数のアプリケーションを作成できます。コマンドラインで指定するラベルは、単一コマンドで作成されるすべてのオブジェクトに適用されます。環境変数は、ソースまたはイメージから作成されたすべてのコンポーネントに適用されます。

ソースリポジトリーおよび Docker Hub イメージからアプリケーションを作成するには、以下を実行します。

$ oc new-app https://github.com/openshift/ruby-hello-world mysql

ソースコードリポジトリーおよびビルダーイメージが別個の引数として指定されている場合、new-app はソースコードリポジトリーのビルダーとしてそのビルダーイメージを使用します。これを意図していない場合は、~ セパレーターを使用してソースに必要なビルダーイメージを指定します。

3.3.4.8. 単一 Pod でのイメージとソースのグループ化

new-app コマンドにより、単一 Pod に複数のイメージをまとめてデプロイできます。グループ化するイメージを指定するには + セパレーターを使用します。--group コマンドライン引数をグループ化する必要のあるイメージを指定する際に使用することもできます。ソースリポジトリーからビルドされたイメージを別のイメージと共にグループ化するには、そのビルダーイメージをグループで指定します。

$ oc new-app ruby+mysqlソースからビルドされたイメージと外部のイメージをまとめてデプロイするには、以下を実行します。

$ oc new-app \

ruby~https://github.com/openshift/ruby-hello-world \

mysql \

--group=ruby+mysql3.3.4.9. イメージ、テンプレート、および他の入力の検索

イメージ、テンプレート、および oc new-app コマンドの他の入力内容を検索するには、--search フラグおよび --list フラグを追加します。たとえば、PHP を含むすべてのイメージまたはテンプレートを検索するには、以下を実行します。

$ oc new-app --search php第4章 Topology ビューを使用したアプリケーション設定の表示

Web コンソールの Developer パースペクティブにある Topology ビューは、プロジェクト内のすべてのアプリケーション、それらのビルドステータスおよびアプリケーションに関連するコンポーネントとサービスを視覚的に表示します。

4.1. 前提条件

Topology ビューでアプリケーションを表示し、それらと対話するには、以下を確認します。

- Web コンソールにログインしている。

- OpenShift Container Platform でアプリケーションおよび他のワークロードを作成するための適切なプロジェクト内の ロールおよびパーミッション がある。

- Developer パースペクティブを使用して OpenShift Container Platform でアプリケーションを作成し、デプロイしている。

- Developer パースペクティブ を使用している。

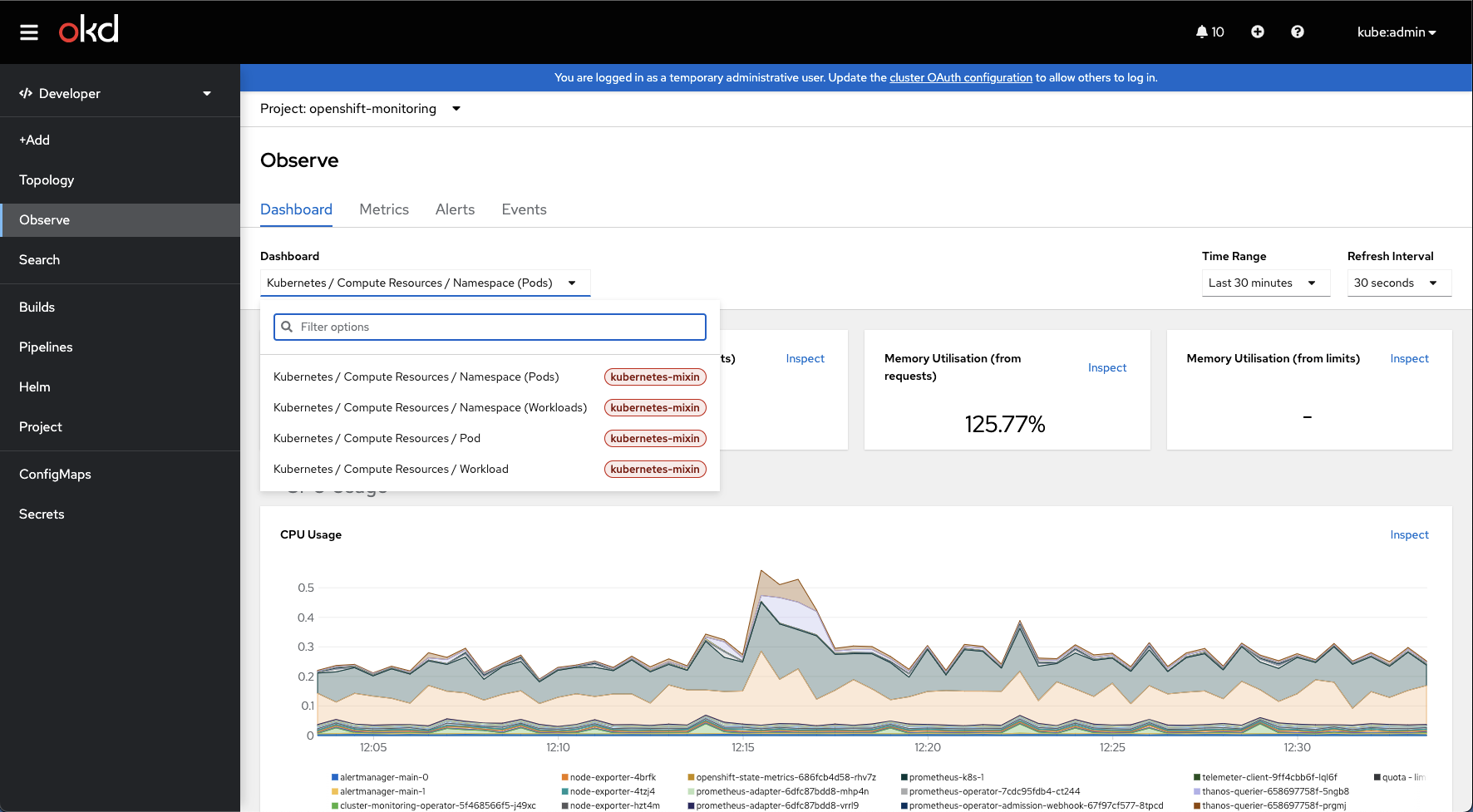

4.2. アプリケーションのトポロジーの表示

Developer パースペクティブの左側のナビゲーションパネルを使用すると、Topology ビューに移動できます。アプリケーションをデプロイしたら、Graph view に自動的に移動します。ここでは、アプリケーション Pod のステータスの確認、パブリック URL でのアプリケーションへの迅速なアクセス、ソースコードへのアクセスとその変更、最終ビルドのステータスの確認ができます。ズームインおよびズームアウトにより、特定のアプリケーションの詳細を表示することができます。

Topology ビューは、List ビューを使用してアプリケーションを監視するオプションも提供します。List view アイコン (

![]() ) を使用してすべてのアプリケーションの一覧を表示し、 Graph view アイコン (

) を使用してすべてのアプリケーションの一覧を表示し、 Graph view アイコン (

![]() ) を使用してグラフビューに戻します。

) を使用してグラフビューに戻します。

以下を使用して、必要に応じてビューをカスタマイズできます。

- Find by name フィールドを使用して、必要なコンポーネントを見つけます。検索結果は表示可能な領域外に表示される可能性があります。その場合、画面の左下のツールバーで Fit to Screen をクリックし、Topology ビューのサイズを変更して、すべてのコンポーネントを表示します。

Display Options ドロップダウンリストを使用して、各種アプリケーショングループの Topology ビューを設定します。選択可能なオプションは、プロジェクトにデプロイされるコンポーネントのタイプによって異なります。

モード (Connectivity または Consumption)

- Connectivity: トポロジー内の異なるノード間の接続をすべて表示する際に選択します。

- Consumption: トポロジー内のすべてのノードのリソース消費を表示する際に選択します。

Expand グループ

- Virtual Machines: 仮想マシンを表示または非表示にするためにこれを切り替えます。

- Application Groupings: アプリケーショングループとそれに関連するアラートの概要を使用して、アプリケーショングループをカードにまとめるには、これをクリアします。

- Helm Releases: 指定のリリースの概要を使用して、Helm リリースとしてデプロイされたコンポーネントをカードにまとめるには、これをクリアします。

- Knative Services: 指定のコンポーネントの概要を使用して Knative Service コンポーネントをカードにまとめるには、これをクリアします。

- Operator Groupings: 指定のグループの概要を使用して Operator でデプロイされたコンポーネントをカードにまとめるには、これをクリアします。

Pod 数 または ラベルに基づく Show の要素

- Pod Count: コンポーネントアイコンでコンポーネントの Pod 数を表示するためにこれを選択します。

- Labels: コンポーネントラベルを表示または非表示にするためにこれを選択します。

トポロジー ビューには、アプリケーションを ZIP ファイル形式でダウンロードするための アプリケーションのエクスポート オプションも用意されています。その後、ダウンロードしたアプリケーションを別のプロジェクトまたはクラスターにインポートできます。詳細については、追加リソース セクションの 別のプロジェクトまたはクラスターへのアプリケーションのエクスポート を参照してください。

4.3. アプリケーションおよびコンポーネントとの対話

Web コンソールの Developer パースペクティブの Topology ビューは、アプリケーションおよびコンポーネントと対話するために以下のオプションを提供します。

-

Open URL (

) をクリックして、パブリック URL のルートで公開されるアプリケーションを表示します。

) をクリックして、パブリック URL のルートで公開されるアプリケーションを表示します。

Edit Source code をクリックして、ソースコードにアクセスし、これを変更します。

注記この機能は、From Git、From Catalog、および From Dockerfile オプションを使用してアプリケーションを作成する場合にのみ利用できます。

-

カーソルを Pod の左下のアイコンの上に置き、最新ビルドおよびそのステータスを確認します。アプリケーションビルドのステータスは、New (

)、Pending ()、Running (

)、Pending ()、Running (

)、Completed (

)、Completed (

)、Failed (

)、Failed (

)、および Canceled (

)、および Canceled (

) と表示されます。

) と表示されます。

Pod のステータスまたはフェーズは、色で区別され、ツールチップで次のように表示されます。

-

Running (

): Pod はノードにバインドされ、すべてのコンテナーが作成されます。1 つ以上のコンテナーが実行中か、起動または再起動のプロセスが実行中です。

): Pod はノードにバインドされ、すべてのコンテナーが作成されます。1 つ以上のコンテナーが実行中か、起動または再起動のプロセスが実行中です。

-

Not Ready(

): 複数のコンテナーを実行している Pod。すべてのコンテナーが準備状態にある訳ではありません。

): 複数のコンテナーを実行している Pod。すべてのコンテナーが準備状態にある訳ではありません。

-

Warning(

): Pod のコンテナーは終了されていますが、正常に終了しませんでした。一部のコンテナーは、他の状態にある場合があります。

): Pod のコンテナーは終了されていますが、正常に終了しませんでした。一部のコンテナーは、他の状態にある場合があります。

-

Failed(

): Pod 内のすべてのコンテナーは終了しますが、少なくとも 1 つのコンテナーが終了に失敗しました。つまり、コンテナーはゼロ以外のステータスで終了するか、システムによって終了された状態であるかのいずれかになります。

): Pod 内のすべてのコンテナーは終了しますが、少なくとも 1 つのコンテナーが終了に失敗しました。つまり、コンテナーはゼロ以外のステータスで終了するか、システムによって終了された状態であるかのいずれかになります。

-

Pending(

): Pod は Kubernetes クラスターによって受け入れられますが、1 つ以上のコンテナーが設定されておらず、実行される準備が整っていません。これには、Pod がスケジュールされるのを待機する時間や、ネットワーク経由でコンテナーイメージのダウンロードに費やされた時間が含まれます。

): Pod は Kubernetes クラスターによって受け入れられますが、1 つ以上のコンテナーが設定されておらず、実行される準備が整っていません。これには、Pod がスケジュールされるのを待機する時間や、ネットワーク経由でコンテナーイメージのダウンロードに費やされた時間が含まれます。

-

Succeeded(

): Pod のすべてのコンテナーが正常に終了し、再起動されません。

): Pod のすべてのコンテナーが正常に終了し、再起動されません。

-

Terminating(

): Pod が削除されている場合に、一部の kubectl コマンドによって Terminating と表示されます。Terminating ステータスは Pod フェーズのいずれにもありません。Pod には正常な終了期間が付与されます。これはデフォルトで 30 秒に設定されます。

): Pod が削除されている場合に、一部の kubectl コマンドによって Terminating と表示されます。Terminating ステータスは Pod フェーズのいずれにもありません。Pod には正常な終了期間が付与されます。これはデフォルトで 30 秒に設定されます。

-

Unknown(

): Pod の状態を取得できませんでした。このフェーズは、通常、Pod が実行されているノードとの通信でエラーが発生するために生じます。

): Pod の状態を取得できませんでした。このフェーズは、通常、Pod が実行されているノードとの通信でエラーが発生するために生じます。

-

Running (

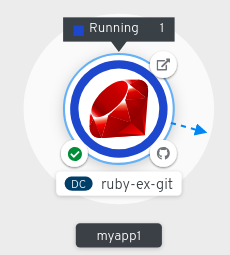

アプリケーションを作成し、イメージがデプロイされると、ステータスは Pending と表示されます。アプリケーションをビルドすると、Runningと表示されます。

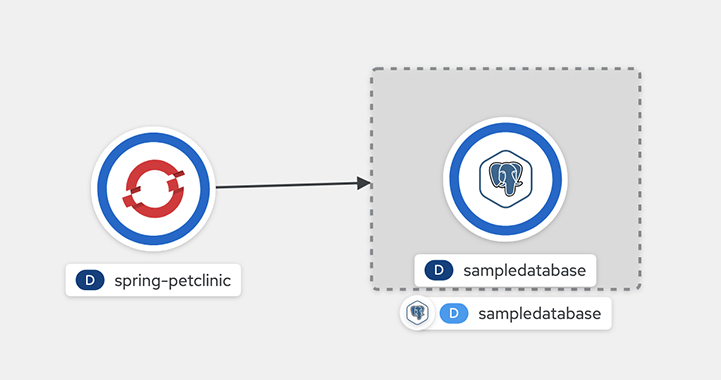

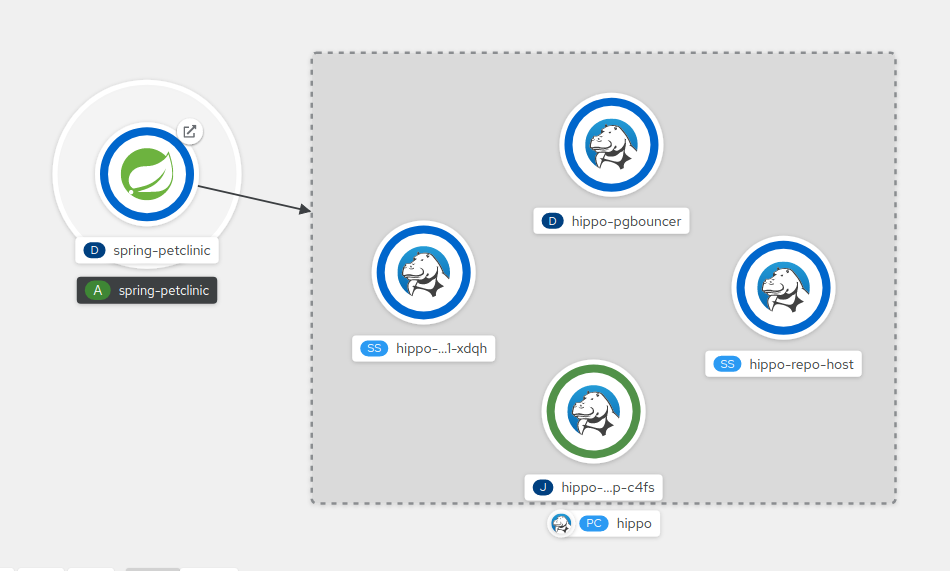

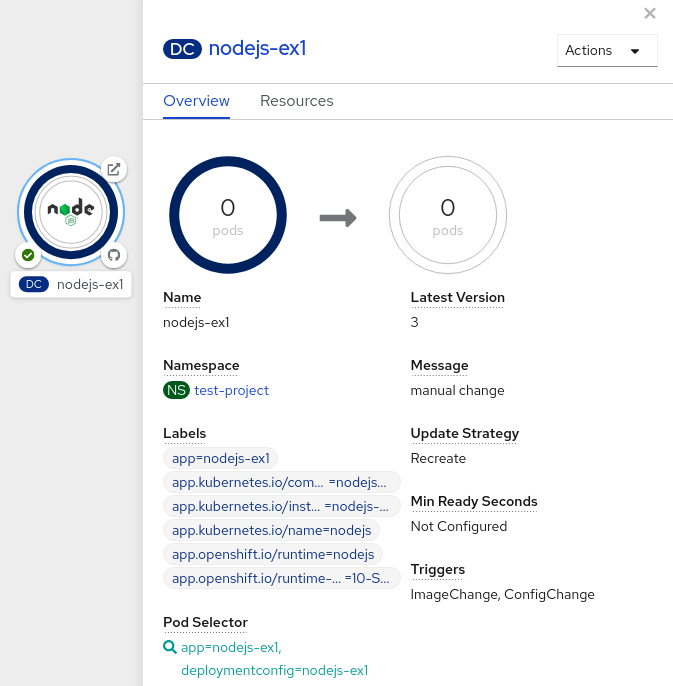

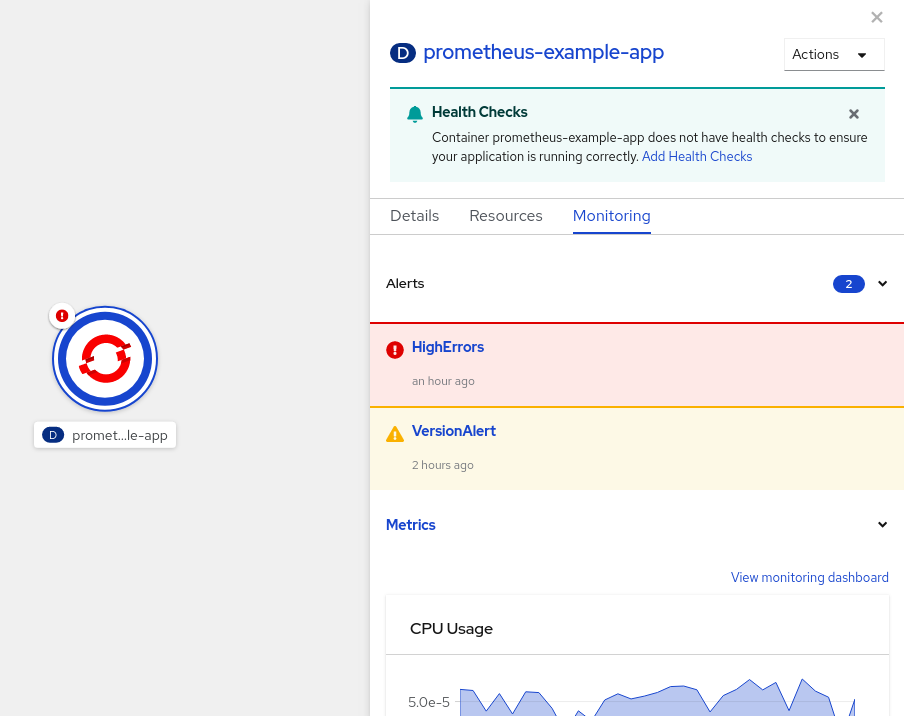

図4.1 Application トポロジー

以下のように、異なるタイプのリソースオブジェクトのインジケーターと共に、アプリケーションリソース名が追加されます。

-

CJ:

CronJob -

D:

Deployment -

DC:

DeploymentConfig -

DS:

DaemonSet -

J:

Job -

P:

Pod -

SS:

StatefulSet  (Knative): サーバーレスアプリケーション

注記

(Knative): サーバーレスアプリケーション

注記サーバーレスアプリケーションでは、Graph view での読み込みおよび表示にしばらく時間がかかります。サーバーレスアプリケーションをデプロイすると、これは最初にサービスリソースを作成し、次にリビジョンを作成します。続いて、これは Graph view にデプロイされ、表示されます。これが唯一のワークロードの場合には、Add ページにリダイレクトされる可能性があります。リビジョンがデプロイされると、サーバーレスアプリケーションは Graph view ビューに表示されます。

-

CJ:

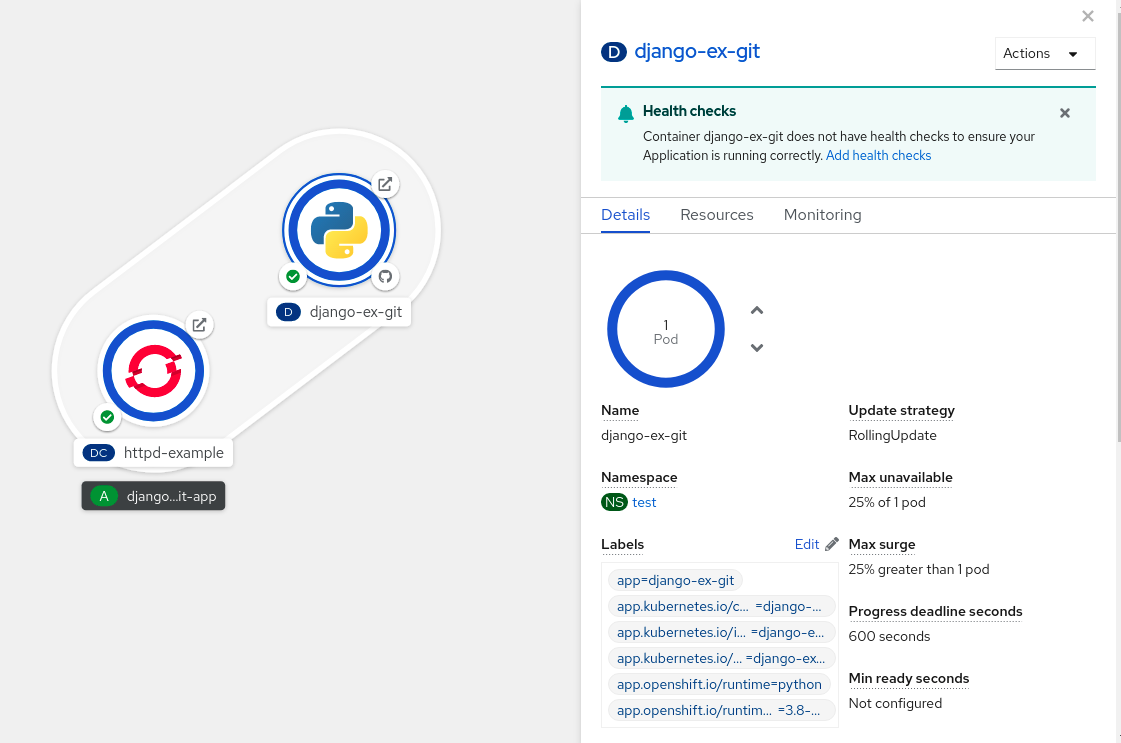

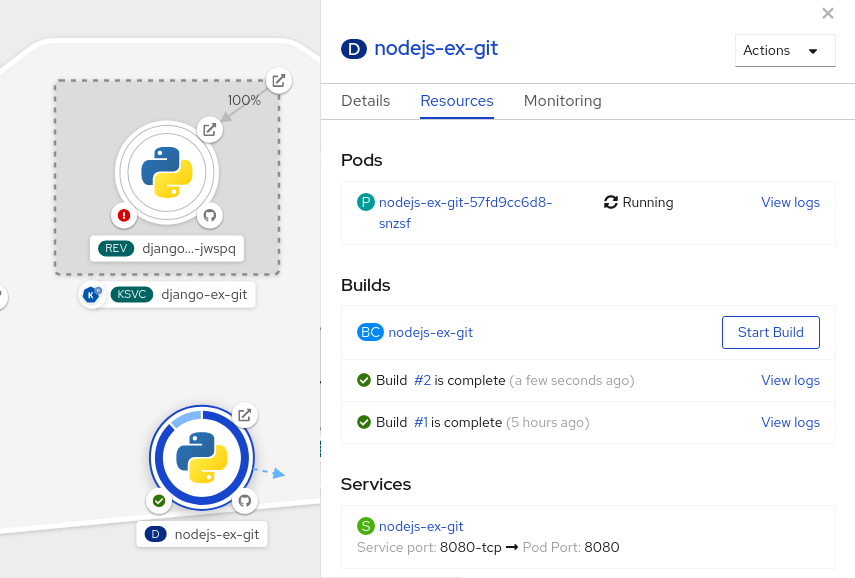

4.4. アプリケーション Pod のスケーリングおよびビルドとルートの確認

Topology ビューは、Overview パネルでデプロイ済みのコンポーネントの詳細を提供します。Overview および Resources タブを使用して、アプリケーション Pod をスケーリングし、ビルドのステータス、サービスおよびルートについて以下のように確認できます。

コンポーネントノードをクリックし、右側の Overview パネルを確認します。Overview タブを使用して、以下を実行します。

- 上下の矢印を使用して Pod をスケーリングし、アプリケーションのインスタンス数の増減を手動で調整します。サーバーレスアプリケーションの場合、Pod は、チャネルのトラフィックに基づいてアイドルおよびスケールアップ時に自動的にゼロにスケーリングされます。

- アプリケーションの ラベル、アノテーション および ステータス を確認します。

Resources タブをクリックして、以下を実行します。

- すべての Pod のリストを確認し、それらのステータスを表示し、ログにアクセスし、Pod をクリックして Pod の詳細を表示します。

- ビルド、ステータスを確認し、ログにアクセスし、必要に応じて新規ビルドを開始します。

- コンポーネントによって使用されるサービスとルートを確認します。

サーバーレスアプリケーションの場合、Resources タブは、そのコンポーネントに使用されるリビジョン、ルート、および設定に関する情報を提供します。

4.5. コンポーネントの既存プロジェクトへの追加

手順

-

Add to Project (

) をクリックし、左側のナビゲーションペインまたは Ctrl+Spaceを押します。

) をクリックし、左側のナビゲーションペインまたは Ctrl+Spaceを押します。

- コンポーネントを検索し、Create または Enter を押してコンポーネントをアプリケーションに追加し、トポロジーの Graph ビュー に表示します。

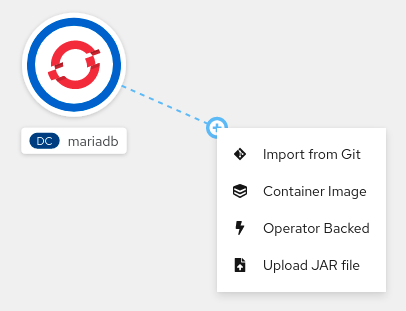

図4.2 クイック検索を使用したコンポーネントの追加

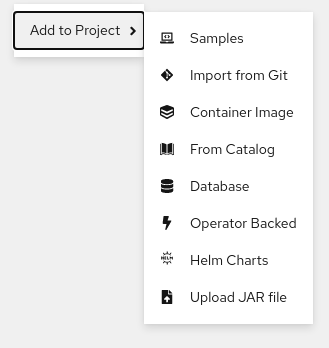

または、トポロジーのGraph viewを右クリックしてプロジェクトにコンポーネントを追加して、コンテキストメニューの Import from Git、Container Image、Database、From Catalog、Operator Backed、Helm Charts、Samples またあ Upload JAR file オプションも使用できます。

図4.3 サービスを追加するコンテキストメニュー

4.6. アプリケーション内での複数コンポーネントのグループ化

+Add ビューを使用して、複数のコンポーネントまたはサービスをプロジェクトに追加し、Topology ビューを使用してアプリケーショングループ内のアプリケーションとリソースをグループ化できます。

前提条件

- Developer パースペクティブを使用して OpenShift Container Platform に 2 つ以上のコンポーネントを作成し、デプロイしていること。

手順

サービスを既存のアプリケーショングループに追加するには、Shift+ を既存のアプリケーショングループに追加します。コンポーネントをドラッグし、これをアプリケーショングループに追加すると、必要なラベルがコンポーネントに追加されます。

図4.4 アプリケーションのグループ化

または、以下のようにコンポーネントをアプリケーションに追加することもできます。

- サービス Pod をクリックし、右側の Overview パネルを確認します。

- Actions ドロップダウンメニューをクリックし、Edit Application Grouping を選択します。

- Edit Application Grouping ダイアログボックスで、Application ドロップダウンリストをクリックし、適切なアプリケーショングループを選択します。

- Save をクリックしてサービスをアプリケーショングループに追加します。

アプリケーショングループからコンポーネントを削除するには、コンポーネントを選択し、Shift+ ドラッグでこれをアプリケーショングループからドラッグします。

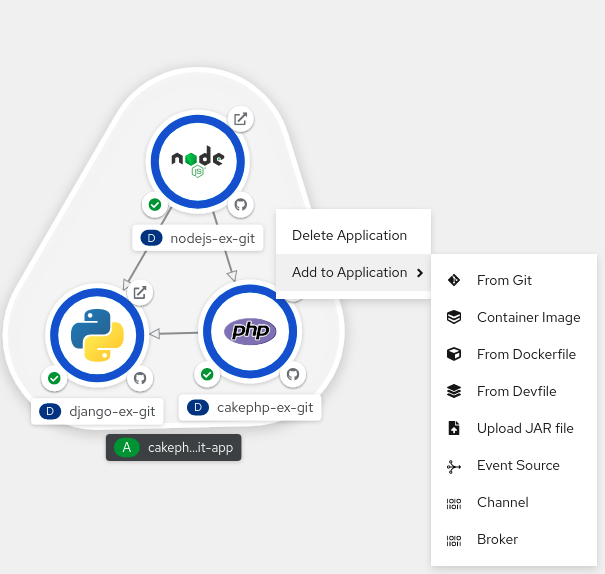

4.7. サービスのアプリケーションへの追加

アプリケーションにサービスを追加するには、トポロジー Graph view のコンテキストメニューで+Add アクションを使用します。

コンテキストメニュー以外に、サイドバーを使用するか、アプリケーショングループから矢印の上にマウスをかざしてドラッグしてサービスを追加できます。

手順

トポロジー Graph view でアプリケーショングループを右クリックし、コンテキストメニューを表示します。

図4.5 リソースコンテキストメニューの追加

- Add to Application を使用して、From Git、Container Image、From Dockerfile、From Devfile、Upload JAR file、Event Source、Channel、または Broker など、アプリケーショングループにサービスを追加する手法を選択します。

- 選択した手法のフォームに入力して、Create をクリックします。たとえば、Git リポジトリーのソースコードに基づいてサービスを追加するには、From Git の手法を選択し、Import from Git フォームに入力して、Create をクリックします。

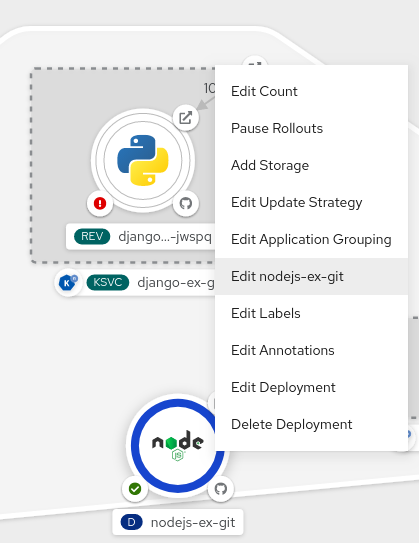

4.8. アプリケーションからのサービスの削除

トポロジー Graph view のコンテキストメニューでアプリケーションからサービスを削除します。

手順

- トポロジー Graph view でアプリケーショングループのサービスを右クリックし、コンテキストメニューを表示します。

Delete Deployment を選択してサービスを削除します。

図4.6 デプロイメントオプションの削除

4.9. Topology ビューに使用するラベルとアノテーション

Topology ビューは、以下のラベルおよびアノテーションを使用します。

- ノードに表示されるアイコン

-

ノードのアイコンは、最初に

app.openshift.io/runtimeラベルを使用してからapp.kubernetes.io/nameラベルを使用して一致するアイコンを検索して定義されます。このマッチングは、事前定義されたアイコンセットを使用して行われます。 - ソースコードエディターまたはソースへのリンク

-

app.openshift.io/vcs-uriアノテーションは、ソースコードエディターへのリンクを作成するために使用されます。 - ノードコネクター

-

app.openshift.io/connects-toアノテーションは、ノードに接続するために使用されます。 - アプリケーションのグループ化

-

app.kubernetes.io/part-of=<appname>ラベルは、アプリケーション、サービス、およびコンポーネントをグループ化するために使用されます。

OpenShift Container Platform アプリケーションで使用する必要のあるラベルとアノテーションの詳細については、Guidelines for labels and annotations for OpenShift applications を参照してください。

第5章 アプリケーションのエクスポート

開発者は、アプリケーションを ZIP ファイル形式でエクスポートできます。必要に応じて、+ Add ビューの YAML のインポート オプションを使用して、エクスポートされたアプリケーションを同じクラスターまたは別のクラスター内の別のプロジェクトにインポートします。アプリケーションをエクスポートすると、アプリケーションリソースを再利用でき、時間を節約できます。

5.1. 前提条件

Operator Hub から gitops-primer Operator をインストールしました。

注記gitops-primer Operator をインストールした後でも、トポロジー ビューで アプリケーションのエクスポート オプションが無効になります。

- トポロジー ビューでアプリケーションを作成し、アプリケーションの エクスポート を有効にしました。

5.2. 手順

開発者パースペクティブで、次のいずれかの手順を実行します。

- + Add ビューに移動し、アプリケーションの移植性 タイルで アプリケーションのエクスポート をクリックします。

- トポロジー ビューに移動し、アプリケーションのエクスポート をクリックします。

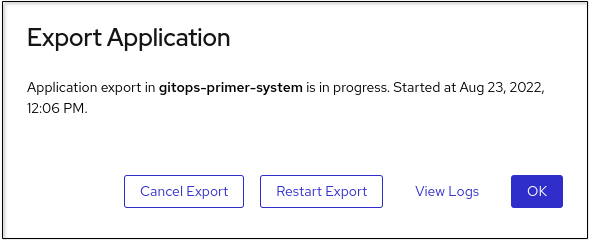

- アプリケーションのエクスポート ダイアログボックスで OK をクリックします。プロジェクトからのリソースのエクスポートが開始されたことを確認する通知が開きます。

次のシナリオで実行する必要があるオプションの手順:

- 不適切なアプリケーションのエクスポートを開始した場合は、アプリケーションのエクスポート → エクスポート の キャンセル をクリックします。

- エクスポートがすでに進行中で、新たにエクスポートを開始する場合は、アプリケーションのエクスポート → エクスポート の 再開 をクリックします。

アプリケーションのエクスポートに関連するログを表示するには、アプリケーションのエクスポート をクリックし、ログの表示 リンクをクリックします。

- エクスポートが正常に完了したら、ダイアログボックスで ダウンロード をクリックして、アプリケーションリソースを ZIP 形式でマシンにダウンロードします。

第6章 アプリケーションのサービスへの接続

6.1. Service Binding Operator のリリースノート

サービスバインディング Operator は、サービスバインディングのコントローラーおよび付随のカスタムリソース定義 (CRD) で設定されます。サービスバインディング Operator は、ワークロードおよびバッキングサービスのデータプレーンを管理します。サービスバインディングコントローラーは、バッキングサービスのコントロールプレーン提供のデータを読み取ります。次に、ServiceBinding リソースで指定されるルールに従って、このデータをワークロードに追加します。

サービスバインディング Operator を使用すると、以下を行うことができます。

- ワークロードを Operator 管理のバッキングサービスと共にバインドします。

- バインディングデータの設定を自動化します。

- サービスオペレーターは簡単にサービスへのアクセスのプロビジョニングや管理が行えます。

- クラスター環境の不一致をなくす一貫性がある宣言型サービスバインディングメソッドを使用し、開発ライフサイクルを充実させます。

サービスバインディング Operator のカスタムリソース定義 (CRD) は以下の API をサポートします。

-

Service Binding:

binding.operators.coreos.comAPI グループ -

servicebinding.ioAPI グループを使用した サービスバインディング (仕様 API)。

6.1.1. サポート表

次の表の一部の機能は、テクノロジープレビュー 段階にあります。これらの実験的機能は、実稼働環境での使用を目的としていません。

以下の表では、機能は以下のステータスでマークされています。

- TP: テクノロジープレビュー機能

- GA: 一般公開機能

これらの機能に関しては、Red Hat カスタマーポータルの以下のサポート範囲を参照してください。

| サービスバインディング Operator | API グループとサポート状況 | OpenShift Versions | |

|---|---|---|---|

| バージョン |

|

| |

| 1.3.3 | GA | GA | 4.9-4.12 |

| 1.3.1 | GA | GA | 4.9-4.11 |

| 1.3 | GA | GA | 4.9-4.11 |

| 1.2 | GA | GA | 4.7-4.11 |

| 1.1.1 | GA | TP | 4.7-4.10 |

| 1.1 | GA | TP | 4.7-4.10 |

| 1.0.1 | GA | TP | 4.7-4.9 |

| 1.0 | GA | TP | 4.7-4.9 |

6.1.2. 多様性を受け入れるオープンソースの強化

Red Hat では、コード、ドキュメント、Web プロパティーにおける配慮に欠ける用語の置き換えに取り組んでいます。まずは、マスター (master)、スレーブ (slave)、ブラックリスト (blacklist)、ホワイトリスト (whitelist) の 4 つの用語の置き換えから始めます。この取り組みは膨大な作業を要するため、今後の複数のリリースで段階的に用語の置き換えを実施して参ります。詳細は、弊社の CTO、Chris Wright のメッセージ を参照してください。

6.1.3. Service Binding Operator 1.3.3 のリリースノート

Service Binding Operator 1.3.3 は、OpenShift Container Platform 4.9、4.10、4.11、および 4.12 で利用できるようになりました。

6.1.3.1. 修正された問題

-

この更新の前に、Service Binding Operator のセキュリティー脆弱性

CVE-2022-41717が指摘されていました。この更新により、CVE-2022-41717エラーが修正され、golang.org/x/netパッケージが v0.0.0-20220906165146-f3363e06e74c から v0.4.0 に更新されます。APPSVC-1256 - この更新の前は、プロビジョニングされたサービスは、それぞれのリソースに servicebinding.io/provisioned-service: true アノテーションが設定されている場合にのみ検出され、他のプロビジョニングされたサービスは検出されませんでした。この更新により、検出メカニズムは status.binding.name 属性に基づいて、すべてのプロビジョニングされたサービスを正しく識別します。APPSVC-1204

6.1.4. Service Binding Operator 1.3.1 のリリースノート

Service Binding Operator 1.3.1 が OpenShift Container Platform 4.9、4.10、および 4.11 で利用できるようになりました。

6.1.4.1. 修正された問題

-

この更新以前に、Service Binding Operator におけるセキュリティーの脆弱性

CVE-2022-32149が指摘されていました。この更新により、CVE-2022-32149のエラーが修正され、golang.org/x/textパッケージが v0.3.7 から v0.3.8 に更新されます。APPSVC-1220

6.1.5. Service Binding Operator 1.3 のリリースノート

Service Binding Operator 1.3 が OpenShift Container Platform 4.9、4.10、および 4.11 で利用できるようになりました。

6.1.5.1. 削除された機能

- Service Binding Operator 1.3 では、リソースの使用率を向上させるために Operator Lifecycle Manager (OLM) 記述子機能が削除されました。OLM 記述子の代わりに、CRD アノテーションを使用してバインディングデータを宣言できます。

6.1.6. Service Binding Operator 1.2 のリリースノート

Service Binding Operator 1.2 が OpenShift Container Platform 4.7、4.8、4.9、4.10、および 4.11 で利用可能になりました。

6.1.6.1. 新機能

このセクションでは、Service Binding Operator 1.2 の主な新機能について説明します。

-

optionalのフラグ値をtrueに設定して、Service Binding Operator がアノテーションのオプションフィールドを考慮できるようにします。 -

servicebinding.io/v1beta1リソースのサポート。 - ワークロードの存在を必要とせずに関連するバインディングシークレットを公開することにより、バインド可能なサービスの検出可能性が向上します。

6.1.6.2. 既知の問題

- 現在、OpenShift Container Platform 4.11 に Service Binding Operator をインストールすると、Service Binding Operator のメモリーフットプリントが予想される制限を超えて増加します。ただし、使用率が低い場合、メモリーフットプリントは環境またはシナリオの予想範囲内にとどまります。OpenShift Container Platform 4.10 と比較すると、負荷がかかると、平均および最大メモリーフットプリントの両方が大幅に増加します。この問題は、Service Binding Operator の以前のバージョンでも明らかです。現在、この問題に対する回避策はありません。APPSVC-1200

-

デフォルトでは、展開されたファイルのアクセス許可は 0644 に設定されています。Service Binding Operator は、サービスが

0600などの特定の権限を想定している場合に問題を引き起こす Kubernetes のバグにより、特定の権限を設定できません。回避策として、ワークロードリソース内で実行されているプログラムまたはアプリケーションのコードを変更して、ファイルを/tmpディレクトリーにコピーし、適切な権限を設定することができます。APPSVC-1127 現時点で、Service Binding Operator を 1 つの namespace インストールモードでインストールする場合に発生する基地の問題があります。適切な namespace スコープのロールベースアクセス制御 (RBAC) ルールがないため、サービスバインディング Operator が自動的に検出およびバインドできる既知の Operator がサポートするいくつかのサービスへのアプリケーションのバインドが正常に行われません。これが発生すると、次の例のようなエラーメッセージが生成されます。

エラーメッセージの例

`postgresclusters.postgres-operator.crunchydata.com "hippo" is forbidden: User "system:serviceaccount:my-petclinic:service-binding-operator" cannot get resource "postgresclusters" in API group "postgres-operator.crunchydata.com" in the namespace "my-petclinic"`回避策 1:

all namespacesインストールモードでサービスバインディング Operator をインストールします。その結果、適切なクラスタースコープの RBAC ルールが存在し、バインディングが正常に実行されるようになります。回避策 2: サービスバインディング Operator を

all namespacesインストールモードでインストールできない場合は、サービスバインディング Operator がインストールされている namespace に以下のロールバインディングをインストールします。例:Crunchy Postgres Operator のロールバインディング

kind: RoleBinding apiVersion: rbac.authorization.k8s.io/v1 metadata: name: service-binding-crunchy-postgres-viewer subjects: - kind: ServiceAccount name: service-binding-operator roleRef: apiGroup: rbac.authorization.k8s.io kind: ClusterRole name: service-binding-crunchy-postgres-viewer-role仕様によると、

ClusterWorkloadResourceMappingリソースを変更する場合、Service Binding Operator は以前のバージョンのClusterWorkloadResourceMappingリソースを使用して、今まで反映されていたバインディングデータを削除する必要があります。現在、ClusterWorkloadResourceMappingリソースを変更すると、Service Binding Operator はClusterWorkloadResourceMappingリソースの最新バージョンを使用してバインディングデータを削除します。その結果、{the servicebinding-title} はバインディングデータを誤って削除する可能性があります。回避策として、以下の手順を実施してください。-

対応する

ClusterWorkloadResourceMappingリソースを使用するServiceBindingリソースをすべて削除します。 -

ClusterWorkloadResourceMappingリソースを変更します。 -

手順 1 で削除した

ServiceBindingリソースを再適用します。

-

対応する

6.1.7. Service Binding Operator 1.1.1 のリリースノート

Service Binding Operator 1.1.1 が OpenShift Container Platform 4.7、4.8、4.9、4.10 で利用可能になりました。

6.1.7.1. 修正された問題

-

この更新以前に、Service Binding Operator Helm チャートにおけるセキュリティーの脆弱性

CVE-2021-38561が指摘されていました。この更新により、CVE-2021-38561のエラーが修正され、golang.org/x/textパッケージが v0.3.6 から v0.3.7 に更新されます。APPSVC-1124 -

この更新以前は、Developer Sandbox のユーザーには、

ClusterWorkloadResourceMappingリソースを読み取るための十分なパーミッションがありませんでした。その結果、Service Binding Operator はすべてのサービスバインディングの成功を妨げていました。今回の更新により、Service Binding Operator には、Developer Sandbox ユーザーを含め、認証されたサブジェクトの適切なロールベースのアクセス制御 (RBAC) ルールが含まれるようになりました。これらの RBAC ルールにより、Service Binding Operator は Developer Sandbox ユーザーのClusterWorkloadResourceMappingリソースをget、list、およびwatchして、サービスバインディングを正常に処理できます。APPSVC-1135

6.1.7.2. 既知の問題

現時点で、Service Binding Operator を 1 つの namespace インストールモードでインストールする場合に発生する基地の問題があります。適切な namespace スコープのロールベースアクセス制御 (RBAC) ルールがないため、サービスバインディング Operator が自動的に検出およびバインドできる既知の Operator がサポートするいくつかのサービスへのアプリケーションのバインドが正常に行われません。これが発生すると、次の例のようなエラーメッセージが生成されます。

エラーメッセージの例

`postgresclusters.postgres-operator.crunchydata.com "hippo" is forbidden: User "system:serviceaccount:my-petclinic:service-binding-operator" cannot get resource "postgresclusters" in API group "postgres-operator.crunchydata.com" in the namespace "my-petclinic"`回避策 1:

all namespacesインストールモードでサービスバインディング Operator をインストールします。その結果、適切なクラスタースコープの RBAC ルールが存在し、バインディングが正常に実行されるようになります。回避策 2: サービスバインディング Operator を

all namespacesインストールモードでインストールできない場合は、サービスバインディング Operator がインストールされている namespace に以下のロールバインディングをインストールします。例:Crunchy Postgres Operator のロールバインディング

kind: RoleBinding apiVersion: rbac.authorization.k8s.io/v1 metadata: name: service-binding-crunchy-postgres-viewer subjects: - kind: ServiceAccount name: service-binding-operator roleRef: apiGroup: rbac.authorization.k8s.io kind: ClusterRole name: service-binding-crunchy-postgres-viewer-role現在、

ClusterWorkloadResourceMappingリソースを変更すると、Service Binding Operator は正しい動作を実装しません。回避策として、以下の手順を実施してください。-

対応する

ClusterWorkloadResourceMappingリソースを使用するServiceBindingリソースをすべて削除します。 -

ClusterWorkloadResourceMappingリソースを変更します。 -

手順 1 で削除した

ServiceBindingリソースを再適用します。

-

対応する

6.1.8. Service Binding Operator 1.1 のリリースノート

サービスバインディング Operator が OpenShift Container Platform 4.7、4.8、4.9、4.10 で利用可能になりました。

6.1.8.1. 新機能

このセクションでは、Service Binding Operator 1.1 の主な新機能について説明します。

サービスバインディングオプション

- ワークロードリソースマッピング: セカンダリーワークロードに対してバインディングデータを投影する必要がある場所を正確に定義します。

- ラベルセレクターを使用して新しいワークロードをバインドします。

6.1.8.2. 修正された問題

- この更新以前は、ラベルセレクターを使用してワークロードを取得していたサービスバインディングは、指定されたラベルセレクターに一致する新しいワークロードにサービスバインディングデータを投影しませんでした。その結果、Service Binding Operator はそのような新しいワークロードを定期的にバインドできませんでした。今回の更新により、サービスバインディングは、指定されたラベルセレクターに一致する新しいワークロードにサービスバインディングデータを投影するようになりました。Service Binding Operator は、定期的に新しいワークロードを見つけてバインドを試みるようになりました。APPSVC-1083

6.1.8.3. 既知の問題

現時点で、Service Binding Operator を 1 つの namespace インストールモードでインストールする場合に発生する基地の問題があります。適切な namespace スコープのロールベースアクセス制御 (RBAC) ルールがないため、サービスバインディング Operator が自動的に検出およびバインドできる既知の Operator がサポートするいくつかのサービスへのアプリケーションのバインドが正常に行われません。これが発生すると、次の例のようなエラーメッセージが生成されます。

エラーメッセージの例

`postgresclusters.postgres-operator.crunchydata.com "hippo" is forbidden: User "system:serviceaccount:my-petclinic:service-binding-operator" cannot get resource "postgresclusters" in API group "postgres-operator.crunchydata.com" in the namespace "my-petclinic"`回避策 1:

all namespacesインストールモードでサービスバインディング Operator をインストールします。その結果、適切なクラスタースコープの RBAC ルールが存在し、バインディングが正常に実行されるようになります。回避策 2: サービスバインディング Operator を

all namespacesインストールモードでインストールできない場合は、サービスバインディング Operator がインストールされている namespace に以下のロールバインディングをインストールします。例:Crunchy Postgres Operator のロールバインディング

kind: RoleBinding apiVersion: rbac.authorization.k8s.io/v1 metadata: name: service-binding-crunchy-postgres-viewer subjects: - kind: ServiceAccount name: service-binding-operator roleRef: apiGroup: rbac.authorization.k8s.io kind: ClusterRole name: service-binding-crunchy-postgres-viewer-role現在、

ClusterWorkloadResourceMappingリソースを変更すると、Service Binding Operator は正しい動作を実装しません。回避策として、以下の手順を実施してください。-

対応する

ClusterWorkloadResourceMappingリソースを使用するServiceBindingリソースをすべて削除します。 -

ClusterWorkloadResourceMappingリソースを変更します。 -

手順 1 で削除した

ServiceBindingリソースを再適用します。

-

対応する

6.1.9. Service Binding Operator 1.0.1 のリリースノート

サービスバインディング Operator が OpenShift Container Platform 4.7、4.8 および 4.9 で利用可能になりました。

サービスバインディング Operator 1.0.1 は、以下で実行されている OpenShift Container Platform 4.9 以降をサポートします。

- IBM Power Systems

- IBM Z および LinuxONE

サービスバインディング Operator 1.0.1 のカスタムリソース定義 (CRD) は以下の API をサポートします。

-

Service Binding:

binding.operators.coreos.comAPI グループ Service Binding (Spec API テクノロジープレビュー):

servicebinding.ioAPI グループ重要servicebinding.ioAPI グループを備えた Service Binding (Spec API テクノロジープレビュー) は、テクノロジープレビュー機能のみでの提供です。テクノロジープレビュー機能は、Red Hat 製品サポートのサービスレベルアグリーメント (SLA) の対象外であり、機能的に完全ではない場合があります。Red Hat は、実稼働環境でこれらを使用することを推奨していません。テクノロジープレビュー機能は、最新の製品機能をいち早く提供して、開発段階で機能のテストを行いフィードバックを提供していただくことを目的としています。Red Hat のテクノロジープレビュー機能のサポート範囲に関する詳細は、テクノロジープレビュー機能のサポート範囲 を参照してください。

6.1.9.1. サポート表

現在、今回のリリースに含まれる機能にはテクノロジープレビューのものがあります。これらの実験的機能は、実稼働環境での使用を目的としていません。

以下の表では、機能は以下のステータスでマークされています。

- TP: テクノロジープレビュー機能

- GA: 一般公開機能

これらの機能に関しては、Red Hat カスタマーポータルの以下のサポート範囲を参照してください。

| 機能 | サービスバインディング Operator 1.0.1 |

|---|---|

|

| GA |

|

| TP |

6.1.9.2. 修正された問題

-

今回の更新以前は、

postgresql.k8s.enterpriesedb.io/v1API のClusterカスタムリソース (CR) からデータ値をバインドすると、CR の.metadata.nameフィールドからhostバインディング値が収集されていました。収集されたバインディング値は間違ったホスト名であり、正しいホスト名は.status.writeServiceフィールドで確認できます。今回の更新により、サービスバインディング Operator がバッキングサービス CR からバインディングデータ値を公開するために使用するアノテーションが変更され、.status.writeServiceフィールドからhostバインディング値を収集するようになりました。サービスバインディング Operator はこれらの変更されたアノテーションを使用して、hostおよびproviderのバインディングに正しいホスト名を反映します。APPSVC-1040 -

今回の更新以前は、

postgres-operator.crunchydata.com/v1beta1API のPostgresClusterCR をバインドする際に、バインディングデータ値にデータベース証明書の値が含まれませんでした。その結果、アプリケーションはデータベースへの接続に失敗しました。今回の更新により、サービスバインディング Operator がバッキングサービス CR からバインディングデータを公開するために使用するアノテーションへの変更に、データベース証明書が含まれるようになりました。サービスバインディング Operator はこれらの変更されたアノテーションを使用して、正しいca.crt、tls.crt、およびtls.key証明書ファイルを反映します。APPSVC-1045 -

今回の更新以前は、

pxc.percona.comAPI のPerconaXtraDBClusterカスタムリソース (CR) をバインドする場合、バインディングデータ値にportおよびdatabaseの値が含まれませんでした。アプリケーションがデータベースサービスに正常に接続するには、これらのバインディング値とすでに反映されている他の値が必要です。今回の更新により、サービスバインディング Operator がバッキングサービス CR からバインディングデータ値を公開するために使用するアノテーションが変更され、追加のporおよびdatabaseバインディング値を反映するようになりました。サービスバインディング Operator はこれらの変更されたアノテーションを使用して、アプリケーションがデータベースサービスに正常に接続するために使用できるバインディング値の完全なセットを反映します。APPSVC-1073

6.1.9.3. 既知の問題

現時点で、単一の namespace インストールモードでサービスバインディング Operator をインストールする際に、適切な namespace スコープのロールベースアクセス制御 (RBAC) ルールがないため、サービスバインディング Operator が自動的に検出およびバインドできる既知の Operator がサポートするいくつかのサービスへのアプリケーションのバインドが正常に行われません。さらに、以下のエラーメッセージが生成されます。

エラーメッセージの例

`postgresclusters.postgres-operator.crunchydata.com "hippo" is forbidden: User "system:serviceaccount:my-petclinic:service-binding-operator" cannot get resource "postgresclusters" in API group "postgres-operator.crunchydata.com" in the namespace "my-petclinic"`回避策 1:

all namespacesインストールモードでサービスバインディング Operator をインストールします。その結果、適切なクラスタースコープの RBAC ルールが存在し、バインディングが正常に実行されるようになります。回避策 2: サービスバインディング Operator を

all namespacesインストールモードでインストールできない場合は、サービスバインディング Operator がインストールされている namespace に以下のロールバインディングをインストールします。例:Crunchy Postgres Operator のロールバインディング

kind: RoleBinding apiVersion: rbac.authorization.k8s.io/v1 metadata: name: service-binding-crunchy-postgres-viewer subjects: - kind: ServiceAccount name: service-binding-operator roleRef: apiGroup: rbac.authorization.k8s.io kind: ClusterRole name: service-binding-crunchy-postgres-viewer-role

6.1.10. サービスバインディング Operator 1.0 のリリースノート

サービスバインディング Operator が OpenShift Container Platform 4.7、4.8 および 4.9 で利用可能になりました。

サービスバインディング Operator 1.0 のカスタムリソース定義 (CRD) は以下の API をサポートします。

-

Service Binding:

binding.operators.coreos.comAPI グループ Service Binding (Spec API テクノロジープレビュー):

servicebinding.ioAPI グループ重要servicebinding.ioAPI グループを備えた Service Binding (Spec API テクノロジープレビュー) は、テクノロジープレビュー機能のみでの提供です。テクノロジープレビュー機能は、Red Hat 製品サポートのサービスレベルアグリーメント (SLA) の対象外であり、機能的に完全ではない場合があります。Red Hat は、実稼働環境でこれらを使用することを推奨していません。テクノロジープレビュー機能は、最新の製品機能をいち早く提供して、開発段階で機能のテストを行いフィードバックを提供していただくことを目的としています。Red Hat のテクノロジープレビュー機能のサポート範囲に関する詳細は、テクノロジープレビュー機能のサポート範囲 を参照してください。

6.1.10.1. サポート表

現在、今回のリリースに含まれる機能にはテクノロジープレビューのものがあります。これらの実験的機能は、実稼働環境での使用を目的としていません。

以下の表では、機能は以下のステータスでマークされています。

- TP: テクノロジープレビュー機能

- GA: 一般公開機能

これらの機能に関しては、Red Hat カスタマーポータルの以下のサポート範囲を参照してください。

| 機能 | サービスバインディング Operator 1.0 |

|---|---|

|

| GA |

|

| TP |

6.1.10.2. 新機能

サービスバインディング Operator 1.0 は、以下で実行されている OpenShift Container Platform 4.9 以降をサポートします。

- IBM Power Systems

- IBM Z および LinuxONE

このセクションでは、サービスバインディング Operator 1.0 の主な新機能について説明します。

サービスからのバインディングデータの公開

- CRD、カスタムリソース (CR)、またはリソースに存在するアノテーションをベースにする。

- Operator Lifecycle Manager(OLM) 記述子にある記述子をベースにする。

- プロビジョニングされたサービスのサポート

ワークロードのプロジェクション

- ボリュームマウントを使用してバインディングデータをファイルとしてプロジェクションする。

- バインディングデータを環境変数としてプロジェクションする。

サービスバインディングオプション

- ワークロード namespace とは異なる namespace でバッキングサービスをバインドする。

- バインディングデータを特定のコンテナーワークロードにプロジェクションする。

- バッキングサービス CR が所有するリソースからバインディングデータを自動的に検出する。

- 公開されるバインディングデータからカスタムバインディングデータを作成する。

-

PodSpec以外のワークロードリソースをサポートする。

セキュリティー

- ロールベースアクセス制御 (RBAC) をサポートする。

6.2. サービスバインディング Operator

アプリケーション開発者は、ワークロードをビルドして接続するバッキングサービスへのアクセスが必要です。ワークロードをバッキングサービスに接続するのは、提案するシークレットにアクセスしてワークロードで消費する方法がサービスプロバイダーごとに異なるので、困難です。さらにワークロードのバインドおよびサービスのバッキングを手動で設定して保守する場合には、プロセスが煩雑で効率が悪く、エラーが発生しやすくなります。

サービスバインディング Operator を使用すると、アプリケーション開発者は、手作業でバインディング接続を設定する手順なしに、オペレーターが管理するバッキングサービスとワークロードを簡単にバインドできます。

6.2.1. サービスバインディングの用語

このセクションでは、サービスバインディングで使用される基本用語の概要を説明します。

| サービスバインディング | サービスに関する情報をワークロードに提供するアクションの表現。たとえば、Java アプリケーションと必要なデータベース間で認証情報の交換を確立することなどです。 |

| バッキングサービス | アプリケーションが通常の操作の一部としてネットワーク経由で使用するサービスまたはソフトウェア。たとえば、データベース、メッセージ、REST エンドポイント、イベントストリーム、アプリケーション、アプリケーションパフォーマンスモニター (APM)、またはハードウェアセキュリティーモジュール (HSM) が含まれます。 |

| ワークロード (アプリケーション) | コンテナー内で実行されているプロセス。たとえば、Sprsh Boot アプリケーション、NodeJS Express アプリケーション、Ruby on Rails アプリケーションなどが含まれます。 |

| バインディングデータ | クラスター内で他のリソースの動作を設定するのに使用するサービスに関する情報。たとえば、認証情報、接続の詳細、ボリュームマウント、またはシークレットが含まれます。 |

| バインディング接続 | バインド可能なバッキングサービスとそのバッキングサービスを必要とするアプリケーションなど、接続されたコンポーネント間の相互作用を確立する接続。 |

6.2.2. サービスバインディング Operator

サービスバインディング Operator は、サービスバインディングのコントローラーおよび付随のカスタムリソース定義 (CRD) で設定されます。サービスバインディング Operator は、ワークロードおよびバッキングサービスのデータプレーンを管理します。サービスバインディングコントローラーは、バッキングサービスのコントロールプレーン提供のデータを読み取ります。次に、ServiceBinding リソースで指定されるルールに従って、このデータをワークロードに追加します。

これにより、サービスバインディング Operator は、ワークロードとのバインディングデータを自動的に収集して共有することで、サービスはバッキングサービスまたは外部サービスを使用できます。このプロセスには、バッキングサービスをバインド可能にして、ワークロードとサービスをバインドすることが含まれます。

6.2.2.1. Operator の管理するサービスをバインド可能にする

サービスをバインド可能にするには、Operator プロバイダーは、ワークロードに必要なバインドデータを公開して Operator が提供するサービスとバインドする必要があります。バインディングデータは、バッキングサービスを管理する Operator の CRD で、アノテーションか、記述子として指定できます。

6.2.2.2. ワークロードをバッキングサービスとバインドする

サービスバインディング Operator を使用して、アプリケーション開発者はバインディング接続を確立する意思を宣言する必要があります。バッキングサービスを参照する ServiceBinding CR を作成する必要があります。このアクションにより、サービスバインディング Operator がトリガーされ、公開されたバインディングデータがワークロードにプロジェクションされます。サービスバインディング Operator は、宣言された意図を受けとり、バッキングサービスとワークロードをバインドします。

サービスバインディング Operator の CRD は以下の API をサポートします。

-

Service Binding:

binding.operators.coreos.comAPI グループ -

servicebinding.ioAPI グループを使用した サービスバインディング (仕様 API)。

サービスバインディング Operator を使用すると、以下を行うことができます。

- ワークロードを Operator 管理のバッキングサービスとバインドします。

- バインディングデータの設定を自動化します。

- サービスへのアクセスをプロビジョニングおよび管理するためのロータッチな管理エクスペリエンスをサービス Operator に提供します。

- クラスター環境の不一致をなくす一貫性がある宣言型サービスバインディングメソッドを使用し、開発ライフサイクルを充実させます。

6.2.3. 主な特長

サービスからのバインディングデータの公開

- CRD、カスタムリソース (CR)、またはリソースに存在するアノテーションをベースにする。

ワークロードのプロジェクション

- ボリュームマウントを使用してバインディングデータをファイルとしてプロジェクションする。

- バインディングデータを環境変数としてプロジェクションする。

サービスバインディングオプション

- ワークロード namespace とは異なる namespace でバッキングサービスをバインドする。

- バインディングデータを特定のコンテナーワークロードにプロジェクションする。

- バッキングサービス CR が所有するリソースからバインディングデータを自動的に検出する。

- 公開されるバインディングデータからカスタムバインディングデータを作成する。

-

PodSpec以外のワークロードリソースをサポートする。

セキュリティー

- ロールベースアクセス制御 (RBAC) をサポートする。

6.2.4. API の違い

サービスバインディング Operator の CRD は以下の API をサポートします。

-

Service Binding:

binding.operators.coreos.comAPI グループ -

servicebinding.ioAPI グループを使用した サービスバインディング (仕様 API)。

これらの API グループは両方とも類似した機能を持っていますが、完全に同一ではありません。これらの API グループ間の相違点の完全なリストを次に示します。

| 機能 | binding.operators.coreos.com API グループによるサポート | servicebinding.io API グループによるサポート | 注意 |

|---|---|---|---|

| プロビジョニングされたサービスへのバインド | はい | はい | 該当なし (該当なし) |

| ダイレクトシークレットプロジェクション | はい | はい | 該当なし (該当なし) |

| ファイルとしてバインド | はい | はい |

|

| 環境変数としてバインド | はい | はい |

|

| ラベルセレクターを使用したワークロードの選択 | はい | はい | 該当なし (該当なし) |

|

Detecting binding resources ( | はい | いいえ |

|

| 命名ストラテジー | はい | いいえ |

|

| コンテナーパス | はい | 部分使用 |

|

| コンテナー名のフィルタリング | いいえ | はい |

|

| Secret path | はい | いいえ |

|

| 代替バインディングソース (たとえば、アノテーションからのバインディングデータ) | はい | サービスバインディング Operator によって許可される | この仕様では、プロビジョニングされたサービスとシークレットからバインディングデータを取得するためのサポートが必要です。ただし、仕様を厳密に読むと、他のバインディングデータソースのサポートが許可されていることが示唆されます。この事実を利用して、Service Binding Operator はさまざまなソースからバインディングデータを取得できます (たとえば、アノテーションからバインディングデータを取得するなど)。Service Binding Operator は、両方の API グループでこれらのソースをサポートします。 |

6.3. サービスバインディング Operator のインストール

以下では、クラスター管理者を対象に、サービスバインディング Operator を OpenShift Container Platform クラスターにインストールするプロセスについて説明します。

OpenShift Container Platform 4.7 以降では サービスバインディング Operator をインストールできます。

前提条件

-

cluster-adminパーミッションを持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできる。 - クラスターで Marketplace 機能が有効になっているか、Red Hat Operator カタログソースが手動で設定されています。

6.3.1. Web コンソールを使用したサービスバインディング Operator のインストール

OpenShift Container Platform OperatorHub を使用してサービスバインディング Operator をインストールできます。サービスバインディング Operator をインストールする時に、サービスバインディングの設定に必要なカスタムリソース (CR) は Operator と共に自動的にインストールされます。

手順

- Web コンソールの Administrator パースペクティブで、Operators → OperatorHub に移動します。

-

Filter by keywordボックスを使用して、カタログで

Service Binding Operatorを検索します。Service Binding Operator タイルをクリックします。 - Service Binding Operator ページで Operator についての簡単な説明を参照してください。Install をクリックします。

Install Operator ページで以下を行います。

-

Installation Mode で All namespaces on the cluster (default) を選択します。このモードは、デフォルトの

openshift-operatorsnamespace に Operator をインストールします。これにより、Operator はクラスター内のすべての namespace を監視し、これらの namespace に対して利用可能になります。 - Approval Strategy で Automatic を選択します。これにより、Operator への今後のアップグレードは Operator Lifecycle Manager (OLM) によって自動的に処理されます。Manual 承認ストラテジーを選択すると、OLM は更新要求を作成します。クラスター管理者は、Operator を新規バージョンに更新できるように OLM 更新要求を手動で承認する必要があります。

Update Channel を選択します。

- デフォルトでは、stable チャネルでは、サービスバインディング Operator の安定した最新版のリリースをインストールできます。

-

Installation Mode で All namespaces on the cluster (default) を選択します。このモードは、デフォルトの

Install をクリックします。

注記Operator は

openshift-operatorsnamespace に自動的にインストールされます。- Installed operator - ready for use ペインで、View Operator をクリックします。Operator が Installed Operators ページに一覧表示されます。

- Status が Succeeded に設定されており、サービスバインディング Operator のインストールが正常に行われたことを確認します。

6.3.2. 関連情報

6.4. サービスバインディングの使用

サービスバインディング Operator は、ワークロードおよびバッキングサービスのデータプレーンを管理します。本ガイドでは、データベースインスタンスの作成、アプリケーションのデプロイ、サービスバインディング Operator を使用してアプリケーションとデータベースサービス間のバインディング接続の作成に役立つ例を使用してその手順を説明します。

前提条件

-

cluster-adminパーミッションを持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできる。 -

ocCLI がインストールされている。 - OperatorHub からサービスバインディング Operator をインストールしている。

v5 Update チャネルを使用して、OperatorHub から Crunchy Postgres for Kubernetes Operator の 5.1.2 バージョンをインストールしました。また、インストールした Operator が、

my-petclinicnamespace など、適切な namespace で利用できる。注記oc create namespace my-petclinicコマンドを使用して namespace を作成できます。

6.4.1. PostgreSQL データベースインスタンスの作成

PostgreSQL データベースインスタンスを作成するには、PostgresCluster カスタムリソース (CR) を作成し、データベースを設定する必要があります。

手順

シェルで以下のコマンドを実行して、

my-petclinicnamespace にPostgresClusterCR を作成します。$ oc apply -n my-petclinic -f - << EOD --- apiVersion: postgres-operator.crunchydata.com/v1beta1 kind: PostgresCluster metadata: name: hippo spec: image: registry.developers.crunchydata.com/crunchydata/crunchy-postgres:ubi8-14.4-0 postgresVersion: 14 instances: - name: instance1 dataVolumeClaimSpec: accessModes: - "ReadWriteOnce" resources: requests: storage: 1Gi backups: pgbackrest: image: registry.developers.crunchydata.com/crunchydata/crunchy-pgbackrest:ubi8-2.38-0 repos: - name: repo1 volume: volumeClaimSpec: accessModes: - "ReadWriteOnce" resources: requests: storage: 1Gi EODこの

PostgresClusterCR に追加されたアノテーションは、サービスバインディング接続を有効にし、Operator の調整をトリガーします。この出力では、データベースインスタンスが作成されていることを検証します。

出力例

postgrescluster.postgres-operator.crunchydata.com/hippo createdデータベースインスタンスを作成したら、

my-petclinicnamespace のすべての Pod が実行されていることを確認します。$ oc get pods -n my-petclinic出力 (表示に数分かかる) で、データベースが作成され設定されていることを検証できます。

出力例

NAME READY STATUS RESTARTS AGE hippo-backup-9rxm-88rzq 0/1 Completed 0 2m2s hippo-instance1-6psd-0 4/4 Running 0 3m28s hippo-repo-host-0 2/2 Running 0 3m28sデータベースを設定したら、サンプルアプリケーションをデプロイしてデータベースサービスに接続できます。

6.4.2. Spring PetClinic サンプルアプリケーションのデプロイ

OpenShift Container Platform クラスターに、Spring PetClinic サンプルアプリケーションをデプロイするには、デプロイメント設定を使用し、アプリケーションをテストできるようにローカル環境を設定する必要があります。

手順

シェルで以下のコマンドを実行して、

spring-petclinicアプリケーションをPostgresClusterカスタムリソース (CR) でデプロイします。$ oc apply -n my-petclinic -f - << EOD --- apiVersion: apps/v1 kind: Deployment metadata: name: spring-petclinic labels: app: spring-petclinic spec: replicas: 1 selector: matchLabels: app: spring-petclinic template: metadata: labels: app: spring-petclinic spec: containers: - name: app image: quay.io/service-binding/spring-petclinic:latest imagePullPolicy: Always env: - name: SPRING_PROFILES_ACTIVE value: postgres ports: - name: http containerPort: 8080 --- apiVersion: v1 kind: Service metadata: labels: app: spring-petclinic name: spring-petclinic spec: type: NodePort ports: - port: 80 protocol: TCP targetPort: 8080 selector: app: spring-petclinic EODこの出力では、Spring PetClinic サンプルアプリケーションが作成され、デプロイされていることを確認します。

出力例

deployment.apps/spring-petclinic created service/spring-petclinic created注記Web コンソールの Developer パースペクティブでコンテナーイメージ を使用してアプリケーションをデプロイする場合は、Advanced options の Deployment セクションで以下の環境変数を入力する必要があります。

- Name: SPRING_PROFILES_ACTIVE

- Value: postgres

以下のコマンドを実行して、アプリケーションがまだデータベースサービスに接続されていないことを確認します。

$ oc get pods -n my-petclinic出力に

CrashLoopBackOffステータスが表示されるまで、数分かかります。出力例

NAME READY STATUS RESTARTS AGE spring-petclinic-5b4c7999d4-wzdtz 0/1 CrashLoopBackOff 4 (13s ago) 2m25sこの段階では、Pod は起動に失敗します。アプリケーションとの対話を試みると、エラーが返されます。

サービスを公開して、アプリケーションのルートを作成します。

$ oc expose service spring-petclinic -n my-petclinic出力は、

spring-petclinicサービスが公開され、Spring PetClinic サンプルアプリケーションのルートが作成されたことを確認します。出力例

route.route.openshift.io/spring-petclinic exposed

サービスバインディング Operator を使用すると、アプリケーションをデータベースサービスに接続できるようになります。

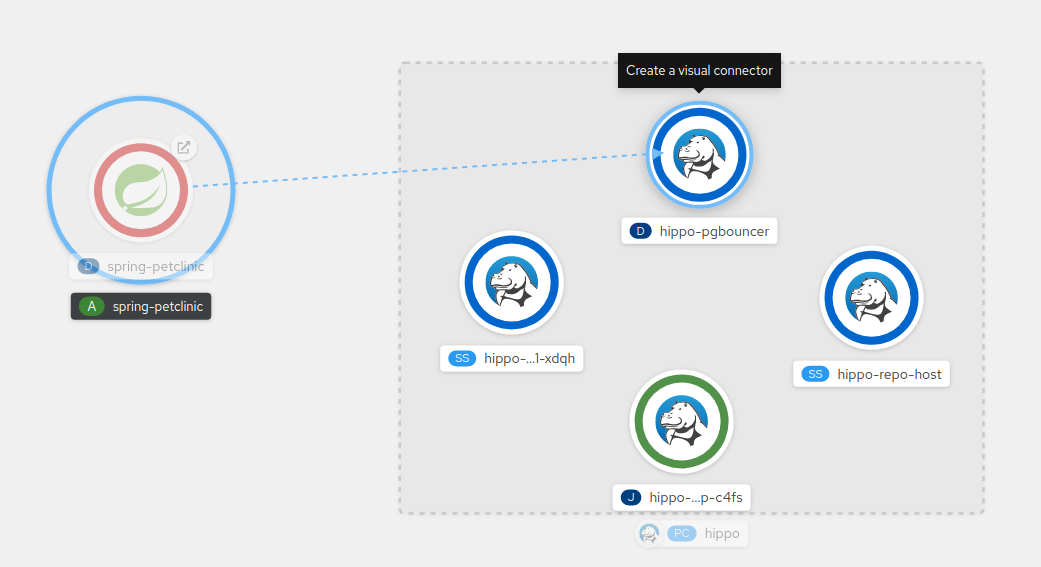

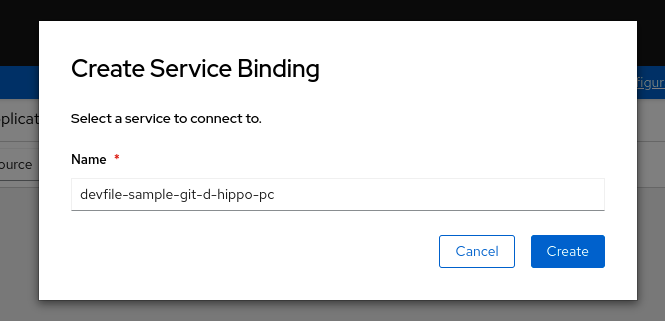

6.4.3. Spring PetClinic サンプルアプリケーションを PostgreSQL データベースサービスに接続します。

サンプルアプリ ks−本をデータベースサービスに接続するには、サービスバインディング Operator がバインディングデータをアプリケーションにプロジェクションするようにトリガーする ServiceBinding カスタムリソース (CR) を作成する必要があります。

手順

ServiceBindingCR を作成し、バインディングデータにパッチを適用します。$ oc apply -n my-petclinic -f - << EOD --- apiVersion: binding.operators.coreos.com/v1alpha1 kind: ServiceBinding metadata: name: spring-petclinic-pgcluster spec: services:1 - group: postgres-operator.crunchydata.com version: v1beta1 kind: PostgresCluster2 name: hippo application:3 name: spring-petclinic group: apps version: v1 resource: deployments EODこの出力では、バインディングデータをサンプルアプリケーションにプロジェクションする

ServiceBindingCR が作成されていることを確認します。出力例

servicebinding.binding.operators.coreos.com/spring-petclinic createdサービスバインディングのリクエストが正常に完了したことを確認します。

$ oc get servicebindings -n my-petclinic出力例

NAME READY REASON AGE spring-petclinic-pgcluster True ApplicationsBound 7sデフォルトでは、データベースサービスのバインディングデータからの値は、サンプルアプリケーションを実行するワークロードコンテナーにファイルとしてプロジェクションされます。たとえば、Secret リソースからの値はすべて

bindings/spring-petclinic-pgclusterディレクトリーに反映されます。注記オプションとして、ディレクトリーの内容を出力して、アプリケーションのファイルに反映されたバインディングデータが含まれることを確認することもできます。

$ for i in username password host port type; do oc exec -it deploy/spring-petclinic -n my-petclinic -- /bin/bash -c 'cd /tmp; find /bindings/*/'$i' -exec echo -n {}:" " \; -exec cat {} \;'; echo; done出力例: シークレットリソースからのすべての値

/bindings/spring-petclinic-pgcluster/username: <username> /bindings/spring-petclinic-pgcluster/password: <password> /bindings/spring-petclinic-pgcluster/host: hippo-primary.my-petclinic.svc /bindings/spring-petclinic-pgcluster/port: 5432 /bindings/spring-petclinic-pgcluster/type: postgresqlアプリケーションポートからポート転送を設定し、ローカル環境からサンプルアプリケーションにアクセスします。

$ oc port-forward --address 0.0.0.0 svc/spring-petclinic 8080:80 -n my-petclinic出力例

Forwarding from 0.0.0.0:8080 -> 8080 Handling connection for 8080http://localhost:8080/petclinic にアクセスします。

localhost:8080 で Spring PetClinic サンプルアプリケーションにリモートでアクセスできるようになり、アプリケーションがデータベースサービスに接続されていることを確認できます。

6.5. IBM Power Systems、IBM Z、および LinuxONE でのサービスバインディングの使用

サービスバインディング Operator は、ワークロードおよびバッキングサービスのデータプレーンを管理します。本ガイドでは、データベースインスタンスの作成、アプリケーションのデプロイ、サービスバインディング Operator を使用してアプリケーションとデータベースサービス間のバインディング接続の作成に役立つ例を使用してその手順を説明します。

前提条件

-

cluster-adminパーミッションを持つアカウントを使用して OpenShift Container Platform クラスターにアクセスできる。 -

ocCLI がインストールされている。 - OperatorHub からサービスバインディング Operator をインストールしている。

6.5.1. PostgreSQL Operator のデプロイ

手順

-

my-petclinicnamespace に Dev4Devs PostgreSQL Operator をデプロイするには、シェルで以下のコマンドを実行します。

$ oc apply -f - << EOD

---

apiVersion: v1

kind: Namespace

metadata:

name: my-petclinic

---

apiVersion: operators.coreos.com/v1

kind: OperatorGroup

metadata:

name: postgres-operator-group

namespace: my-petclinic

---

apiVersion: operators.coreos.com/v1alpha1

kind: CatalogSource

metadata:

name: ibm-multiarch-catalog

namespace: openshift-marketplace

spec:

sourceType: grpc

image: quay.io/ibm/operator-registry-<architecture>

imagePullPolicy: IfNotPresent

displayName: ibm-multiarch-catalog

updateStrategy:

registryPoll:

interval: 30m

---

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: postgresql-operator-dev4devs-com

namespace: openshift-operators

spec:

channel: alpha

installPlanApproval: Automatic

name: postgresql-operator-dev4devs-com

source: ibm-multiarch-catalog

sourceNamespace: openshift-marketplace

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:

name: database-view

labels:

servicebinding.io/controller: "true"

rules:

- apiGroups:

- postgresql.dev4devs.com

resources:

- databases

verbs:

- get

- list

EOD- 1

- Operator イメージ

-

IBM Power:

quay.io/ibm/operator-registry-ppc64le:release-4.9 -

For IBM Z および LinuxONE: