スケーラビリティーおよびパフォーマンス

実稼働環境における OpenShift Container Platform クラスターのスケーリングおよびパフォーマンスチューニング

概要

第1章 OpenShift Container Platform スケーラビリティーおよびパフォーマンスの概要

OpenShift Container Platform は、クラスターのパフォーマンスとスケーリングを最適化するのに役立つベストプラクティスとツールを提供します。次のドキュメントでは、推奨されるパフォーマンスとスケーラビリティーのプラクティス、リファレンス設計仕様、最適化、低レイテンシーのチューニングに関する情報を提供します。

Red Hat サポートへの問い合わせは、サポート を参照してください。

一部のパフォーマンス Operator およびスケーラビリティー Operator には、OpenShift Container Platform のリリースサイクルとは独立したリリースサイクルがあります。詳細は、OpenShift Operators を参照してください。

1.1. パフォーマンスとスケーラビリティの推奨プラクティス

1.2. 通信事業者リファレンス設計仕様

1.3. 計画、最適化、測定

IBM Z および IBM LinuxONE の推奨プラクティス

CPU マネージャーおよび Topology Manager の使用

ストレージ、ルーティング、ネットワーク、CPU 使用率の最適化

huge page の機能およびそれらがアプリケーションによって消費される仕組み

クラスターの安定性とパーティションワークロードを改善するための低レイテンシーチューニング

第2章 パフォーマンスとスケーラビリティの推奨プラクティス

2.1. コントロールプレーンの推奨プラクティス

OpenShift Container Platform におけるコントロールプレーンの推奨パフォーマンスとスケーラビリティープラクティスを確認してください。この作業を行うことで、コンピュートマシンの数をより適切に拡張し、クラスターのコントロールプレーンノードのサイズを設定できます。

2.1.1. クラスターのスケーリングに関する推奨プラクティス

クラウドプロバイダー上にクラスターをインストールする場合は、クラスターのスケーリングに関する推奨事項を確認してください。

OpenShift Container Platform クラスター内のコンピュートマシンの数を拡張するには、以下のベストプラクティスを適用してください。ワーカーマシンをスケーリングするには、コンピュートマシンセットで定義されているレプリカの数を増減させます。

クラスターをノード数のより高い値にスケールアップする場合:

- 高可用性を確保するために、ノードを利用可能なすべてのゾーンに分散します。

- 一度に 25 台から 50 台までの範囲でマシンをスケールアップします。

-

定期的なプロバイダーの容量関連の制約を軽減するために、同様のサイズの別のインスタンスタイプを使用して、利用可能なゾーンごとに新規のコンピュートマシンセットを作成することを検討してください。たとえば、AWS では

m5.largeとm5d.largeを使用します。

クラウドプロバイダーは API サービスのクォータを実装する可能性があります。そのため、クラスターは段階的にスケーリングします。

コンピュートマシンセット内のレプリカがすべて一度に高い数値に設定されると、コントローラーがマシンを作成できない可能性があります。このプロセスには、OpenShift Container Platform がデプロイされているクラウドプラットフォームが処理できる要求の数が影響します。コントローラーは、マシンを作成、確認、およびステータスを更新しようとする際に、より多くのクエリーを実行します。OpenShift Container Platform がデプロイされるクラウドプラットフォームには API 要求の制限があり、過剰なクエリーが生じると、クラウドプラットフォームの制限によりマシンの作成が失敗する場合があります。

大規模なノード数にスケーリングする際にマシンヘルスチェックを有効にします。障害が発生する場合、ヘルスチェックは状態を監視し、正常でないマシンを自動的に修復します。

大規模で高密度なクラスターをスケールダウンしてノード数を減らす場合、長い時間がかかることがあります。このプロセスでは、終了するノードで実行されているオブジェクトを並行して drain または退避させる必要があるためです。また、退避させるオブジェクトが多すぎる場合、クライアントがリクエストのスロットリングを開始する可能性があります。デフォルトの 1 秒あたりのクライアントクエリー数 (QPS) とバーストレートは、現在それぞれ 50 と 100 に設定されています。これらの値は、OpenShift Container Platform では変更できません。

2.1.2. コントロールプレーンノードのサイジング

コントロールプレーンノードのリソース要件は、クラスター内のノードとオブジェクトの数とタイプによって異なります。制御プレーンノードのサイズに関する推奨事項を参照して、ご自身のサイジングニーズをよりよく理解してください。

次のコントロールプレーンノードサイズの推奨事項は、コントロールプレーン密度に焦点を当てたテストまたは クラスター密度 の結果に基づいています。このテストでは、指定された数の namespace にわたって次のオブジェクトを作成します。

- 1 イメージストリーム

- 1 ビルド

-

5 つのデプロイメント、

sleep状態の 2 つの Pod レプリカ、4 つのシークレット、4 つの config map、およびそれぞれ 1 つの下位 API ボリュームのマウント - 5 つのサービス。それぞれが以前のデプロイメントの 1 つの TCP/8080 および TCP/8443 ポートを指します。

- 以前のサービスの最初を指す 1 つのルート

- 2048 個のランダムな文字列文字を含む 10 個のシークレット

- 2048 個のランダムな文字列文字を含む 10 個の config map

| コンピュートノードの数 | クラスター密度 (namespace) | CPU コア数 | メモリー (GB) |

|---|---|---|---|

| 24 | 500 | 4 | 16 |

| 120 | 1000 | 8 | 32 |

| 252 | 4000 | 16、ただし OVN-Kubernetes ネットワークプラグインを使用する場合は 24 | 64、ただし OVN-Kubernetes ネットワークプラグインを使用する場合は 128 |

| 501、ただし OVN-Kubernetes ネットワークプラグインではテストされていません | 4000 | 16 | 96 |

上記の表のデータは、AWS 上で動作する OpenShift Container Platform に基づいており、制御プレーンノードとして r5.4xlarge インスタンス、コンピュートノードとして m5.2xlarge インスタンスを使用しています。

3 つのコントロールプレーンノードを持つ大規模で高密度なクラスターでは、いずれかのノードが停止、再起動、または障害が発生すると、CPU とメモリーの使用量が急増します。障害は、電源、ネットワーク、または基礎となるインフラストラクチャーの予期しない問題、またはコストを節約するためにシャットダウンした後にクラスターが再起動する意図的なケースが原因である可能性があります。残りの 2 つのコントロールプレーンノードは、高可用性を維持するために負荷を処理する必要があります。これにより、リソースの使用量が増えます。この動作はアップグレード時にも予想されます。オペレーティングシステムの更新とコントロールプレーン Operator の更新を適用するために、コントロールプレーンノードに cordon (スケジューリング対象からの除外) と drain (Pod の退避) が実行され、ノードが順次再起動されるためです。障害が繰り返し発生しないようにするには、コントロールプレーンノードでの全体的な CPU およびメモリーリソース使用状況を、利用可能な容量の最大 60% に維持し、使用量の急増に対応できるようにします。リソース不足による潜在的なダウンタイムを回避するために、コントロールプレーンノードの CPU およびメモリーを適宜増やします。

ノードのサイジングは、クラスター内のノードおよびオブジェクトの数によって異なります。また、オブジェクトがそのクラスター上でアクティブに作成されるかどうかによっても異なります。オブジェクトの作成中は、オブジェクトが Running フェーズにあるときと比較して、コントロールプレーンのリソース使用状況がより活発になります。

Operator Lifecycle Manager (OLM) はコントロールプレーンノードで実行されます。OLM のメモリーフットプリントは、クラスターで OLM が管理する必要がある namespaces とユーザーがインストールした Operator の数によって異なります。OOM による強制終了を防ぐには、コントロールプレーンノードのサイズを適切に設定する必要があります。以下のデータポイントは、クラスター最大のテストの結果に基づいています。

| namespace 数 | アイドル状態の OLM メモリー (GB) | ユーザー Operator が 5 つインストールされている OLM メモリー (GB) |

|---|---|---|

| 500 | 0.823 | 1.7 |

| 1000 | 1.2 | 2.5 |

| 1500 | 1.7 | 3.2 |

| 2000 | 2 | 4.4 |

| 3000 | 2.7 | 5.6 |

| 4000 | 3.8 | 7.6 |

| 5000 | 4.2 | 9.02 |

| 6000 | 5.8 | 11.3 |

| 7000 | 6.6 | 12.9 |

| 8000 | 6.9 | 14.8 |

| 9000 | 8 | 17.7 |

| 10,000 | 9.9 | 21.6 |

実行中の OpenShift Container Platform 4.20 クラスターでコントロールプレーンノードのサイズを変更できるのは、以下の構成の場合に限られます。

- ユーザーがプロビジョニングしたインストール方法でインストールされたクラスター。

- installer-provisioned infrastructure インストール方法でインストールされた AWS クラスター。

- コントロールプレーンマシンセットを使用してコントロールプレーンマシンを管理するクラスター。

他のすべての構成では、インストール時に合計ノード数を見積もり、推奨されるコントロールプレーンノードサイズを使用する必要があります。

OpenShift Container Platform 4.20 では、OpenShift Container Platform 3.11 以前のバージョンと比較して、CPU コアの半分 (500 ミリコア) がデフォルトでシステムによって予約されるようになりました。サイズはこれを考慮に入れて決定されます。

2.2. コントロールプレーンマシン用に、より大きな AWS インスタンスタイプを選択する

Amazon Web Services (AWS) クラスター内のコントロールプレーンマシンがより多くのリソースを必要とする場合は、コントロールプレーンマシンが使用するより大きな AWS インスタンスタイプを選択できます。

コントロールプレーンマシンセットを使用するクラスターの手順は、コントロールプレーンマシンセットを使用しないクラスターの手順とは異なります。

クラスター内の ControlPlaneMachineSet CR の状態が不明な場合は、CR の状態を確認できます。

2.2.2. コントロールプレーンマシンセットを使用して Amazon Web Services インスタンスタイプを変更する

コントロールプレーンマシンセットのカスタムリソース (CR) の仕様を更新することで、コントロールプレーンマシンが使用する Amazon Web Services (AWS) インスタンスタイプを変更できます。

前提条件

- AWS クラスターは、コントロールプレーンマシンセットを使用します。

手順

providerSpecフィールドの下で以下の行を編集します。providerSpec: value: ... instanceType: <compatible_aws_instance_type>-

<compatible_aws_instance_type>: 前の選択と同じベースを持つ、より大きな AWS インスタンスタイプを指定します。たとえば、m6i.xlargeをm6i.2xlargeまたはm6i.4xlargeに変更できます。

-

- 変更を保存します。

2.2.3. AWS コンソールを使用して Amazon Web Services インスタンスタイプを変更する

AWS コンソールでインスタンスタイプを更新することにより、コントロールプレーンマシンが使用するアマゾンウェブサービス (AWS) インスタンスタイプを変更できます。

前提条件

- クラスターの EC2 インスタンスを変更するために必要なアクセス許可を持つ AWS コンソールにアクセスできます。

-

cluster-adminロールを持つユーザーとして OpenShift Container Platform クラスターにアクセスできます。

手順

- AWS コンソールを開き、コントロールプレーンマシンのインスタンスを取得します。

コントロールプレーンマシンインスタンスを 1 つ選択します。

- 選択したコントロールプレーンマシンについて、etcd スナップショットを作成して etcd データをバックアップします。詳細は、「etcd のバックアップ」を参照してください。

- AWS コンソールで、コントロールプレーンマシンインスタンスを停止します。

- 停止したインスタンスを選択し、Actions → Instance Settings → Change instance type をクリックします。

-

インスタンスをより大きなタイプに変更し、タイプが前の選択と同じベースであることを確認して、変更を適用します。たとえば、

m6i.xlargeをm6i.2xlargeまたはm6i.4xlargeに変更できます。 - インスタンスを起動します。

-

OpenShift Container Platform クラスターにインスタンスに対応する

Machineオブジェクトがある場合、AWS コンソールで設定されたインスタンスタイプと一致するようにオブジェクトのインスタンスタイプを更新します。

- コントロールプレーンマシンごとにこのプロセスを繰り返します。

2.3. インフラストラクチャーの推奨プラクティス

このトピックでは、OpenShift Container Platform のインフラストラクチャーに関するパフォーマンスとスケーラビリティーの推奨プラクティスを説明します。

2.3.1. インフラストラクチャーノードのサイジング

インフラストラクチャーノード は、OpenShift Container Platform 環境の各部分を実行するようにラベル付けされたノードです。インフラストラクチャーノードのリソース要件は、クラスターの稼働時間、ノード、およびクラスター内のオブジェクトによって異なります。これらの要因により、Prometheus のメトリクスまたは時系列の数が増える可能性があるためです。次のインフラストラクチャーノードサイズの推奨事項は、コントロールプレーンノードのサイジング セクションで詳しく説明されているクラスター密度テストで観察された結果に基づいています。モニタリングスタックとデフォルトの Ingress コントローラーは、これらのノードに移動されています。

| ワーカーノードの数 | クラスター密度または namespace の数 | CPU コア数 | メモリー (GB) |

|---|---|---|---|

| 27 | 500 | 4 | 24 |

| 120 | 1000 | 8 | 48 |

| 252 | 4000 | 16 | 128 |

| 501 | 4000 | 32 | 128 |

通常、3 つのインフラストラクチャーノードはクラスターごとに推奨されます。

これらのサイジングの推奨事項は、ガイドラインとして使用する必要があります。Prometheus はメモリー集約型のアプリケーションであり、リソースの使用率はノード数、オブジェクト数、Prometheus メトリクスの収集間隔、メトリクスまたは時系列、クラスターの使用年数などのさまざまな要素によって異なります。さらに、ルーターのリソース使用量は、ルートの数とインバウンド要求の量/タイプによっても影響を受ける可能性があります。

これらの推奨事項は、クラスターの作成時にインストールされたモニタリング、イングレス、およびレジストリーインフラストラクチャーコンポーネントをホストするインフラストラクチャーノードにのみ適用されます。

OpenShift Container Platform 4.20 では、OpenShift Container Platform 3.11 以前のバージョンと比較して、CPU コアの半分 (500 ミリコア) がデフォルトでシステムによって予約されるようになりました。これは、上記のサイジングの推奨内容に影響します。

2.3.2. Cluster Monitoring Operator のスケーリング

OpenShift Container Platform は、Cluster Monitoring Operator (CMO) が収集し、Prometheus ベースのモニタリングスタックに保存するメトリクスを公開します。管理者は、Observe → Dashboards に移動して、OpenShift Container Platform Web コンソールでシステムリソース、コンテナー、およびコンポーネントメトリックスのダッシュボードを表示できます。

2.3.3. Prometheus データベースのストレージ要件

Red Hat は、スケールサイズに応じて各種のテストを実行しました。

- 次の Prometheus ストレージ要件は規定されていないため、参考として使用してください。ワークロードのアクティビティーおよびリソースの密度に応じて、クラスターでより多くのリソース消費が観察される可能性があります。これには、Pod、コンテナー、ルート、Prometheus により収集されるメトリクスを公開する他のリソースの数が含まれます。

- ストレージ要件に合わせて、サイズベースのデータ保持ポリシーを設定できます。

| ノード数 | Pod 数 (Pod あたり 2 コンテナー) | 1 日あたりの Prometheus ストレージの増加量 | 15 日ごとの Prometheus ストレージの増加量 | ネットワーク (tsdb チャンクに基づく) |

|---|---|---|---|---|

| 50 | 1800 | 6.3 GB | 94 GB | 16 MB |

| 100 | 3600 | 13 GB | 195 GB | 26 MB |

| 150 | 5400 | 19 GB | 283 GB | 36 MB |

| 200 | 7200 | 25 GB | 375 GB | 46 MB |

ストレージ要件が計算値を超過しないようにするために、オーバーヘッドとして予期されたサイズのおよそ 20% が追加されています。

上記の計算は、デフォルトの OpenShift Container Platform Cluster Monitoring Operator に関する計算です。

CPU の使用率による影響は大きくありません。比率は、およそ 50 ノードおよび 1800 Pod ごとに 40 分の 1 コアです。

OpenShift Container Platform に関する推奨事項

- 少なくとも 2 つのインフラストラクチャー (infra) ノードを使用してください。

- Non-Volatile Memory Express (SSD または NVMe) ドライブを備えた少なくとも 3 つの openshift-container-storage ノードを使用します。

2.3.4. クラスターモニタリングの設定

クラスターモニタリングスタック内の Prometheus コンポーネントのストレージ容量を増やすことができます。

手順

Prometheus のストレージ容量を拡張するには、以下を実行します。

YAML 設定ファイル

cluster-monitoring-config.yamlを作成します。以下に例を示します。apiVersion: v1 kind: ConfigMap data: config.yaml: | prometheusK8s: retention: {{PROMETHEUS_RETENTION_PERIOD}}1 nodeSelector: node-role.kubernetes.io/infra: "" volumeClaimTemplate: spec: storageClassName: {{STORAGE_CLASS}}2 resources: requests: storage: {{PROMETHEUS_STORAGE_SIZE}}3 alertmanagerMain: nodeSelector: node-role.kubernetes.io/infra: "" volumeClaimTemplate: spec: storageClassName: {{STORAGE_CLASS}}4 resources: requests: storage: {{ALERTMANAGER_STORAGE_SIZE}}5 metadata: name: cluster-monitoring-config namespace: openshift-monitoring- 1

- Prometheus の保持のデフォルト値は

PROMETHEUS_RETENTION_PERIOD=15dです。時間は、接尾辞 s、m、h、d のいずれかを使用する単位で測定されます。 - 2 4

- クラスターのストレージクラス。

- 3

- 標準の値は

PROMETHEUS_STORAGE_SIZE=2000Giです。ストレージの値には、接尾辞 E、P、T、G、M、K のいずれかを使用した単純な整数または固定小数点整数を使用できます。また、2 のべき乗の値 (Ei、Pi、Ti、Gi、Mi、Ki) を使用することもできます。 - 5

- 標準の値は

ALERTMANAGER_STORAGE_SIZE=20Giです。ストレージの値には、接尾辞 E、P、T、G、M、K のいずれかを使用した単純な整数または固定小数点整数を使用できます。また、2 のべき乗の値 (Ei、Pi、Ti、Gi、Mi、Ki) を使用することもできます。

- 保存期間、ストレージクラス、およびストレージサイズの値を追加します。

- ファイルを保存します。

以下を実行して変更を適用します。

$ oc create -f cluster-monitoring-config.yaml

第3章 通信事業者コアリファレンス設計仕様

通信事業者コアリファレンス設計仕様 (RDS) は、通信事業者コアワークロードをホストする、コモディティーハードウェア上で実行される OpenShift Container Platform クラスターを設定するものです。

3.1. 通信事業者コア RDS 4.20 使用モデルの概要

通信事業者コアリファレンス設計仕様 (RDS) は、シグナリングやアグリゲーションなどのコントロールプレーン機能を含む大規模な通信事業者アプリケーションを支えるプラットフォームを表したものです。また、ユーザープレーン機能 (UPF) などの集中型データプレーン機能もいくつか含まれています。通常、これらの機能には、スケーラビリティー、複雑なネットワークのサポート、耐障害性の高いソフトウェア定義ストレージが必要です。また、RAN などのファーエッジデプロイメントよりも厳密さや制約は少ないものの、パフォーマンス要件への対応も必要です。

3.2. 通信事業者コアクラスター使用モデルについて

通信事業者コアクラスター使用モデルは、コモディティーハードウェア上で実行されるクラスター向けに設計されています。通信事業者コアクラスターは、シグナリング、アグリゲーション、セッションボーダーコントローラー (SBC) などのコントロールプレーン機能や、5G ユーザープレーン機能 (UPF) などの集中型データプレーン機能を含む大規模な通信事業者アプリケーションを支えるものです。通信事業者コアクラスターの機能には、スケーラビリティー、複雑なネットワークサポート、耐障害性の高いソフトウェア定義ストレージが必要です。また、ファーエッジ RAN デプロイメントよりも厳密さや制約は少ないものの、パフォーマンス要件への対応も必要です。

通信事業者コア機能のネットワーク要件は、ネットワーク機能とパフォーマンスポイントの範囲によって大きく異なります。IPv6 が必須であり、デュアルスタックが一般的です。機能によっては、最大のスループットとトランザクションレートや、ユーザープレーン DPDK ネットワークのサポートが必要です。それ以外の機能は、一般的なクラウドネイティブパターンを使用し、OVN-Kubernetes、カーネルネットワーク、負荷分散を利用できます。

通信事業者コアクラスターは、通常、標準の (非リアルタイム) カーネルで構成された 3 つのコントロールプレーンと 1 つ以上のワーカーノードで構成されます。ワーカーノードは、さまざまなネットワークおよびパフォーマンス要件を持つワークロードに対応するために、たとえば非ユーザーデータプレーンや高スループットのユースケース向けに、MachineConfigPool カスタムリソース (CR) を使用してセグメント化できます。通信事業者に必要な運用機能をサポートするために、コアクラスターには Day 2 OLM 管理 Operator の標準セットがインストールされています。

図3.1 通信事業者コア RDS クラスターのサービスベースのアーキテクチャーとネットワークトポロジー

3.3. リファレンス設計の範囲

通信事業者コア、通信事業者 RAN、および通信事業者ハブリファレンス設計仕様 (RDS) は、通信事業者コアおよび通信事業者 RAN プロファイルを実行するクラスターで、信頼性が高く再現性のあるパフォーマンスを実現するために推奨される、テスト済みでサポート対象の設定を表したものです。

各 RDS には、クラスターが個々のプロファイルを実行するために設計および検証された、リリースされた機能とサポートされている設定が含まれています。設定により、機能と KPI ターゲットを満たすベースラインの OpenShift Container Platform インストールが提供されます。各 RDS では、個々の設定ごとに予想される変動も説明します。各 RDS の検証には、長期間にわたる大規模なテストが多数含まれます。

検証済みのリファレンス設定は、OpenShift Container Platform のメジャー Y-stream リリースごとに更新されます。Z-stream パッチリリースは、リファレンス設定に照らして定期的に再テストされます。

3.4. リファレンス設計からの逸脱

検証済みの通信事業者コア、通信事業者 RAN DU、および通信事業者ハブリファレンス設計仕様 (RDS) から逸脱すると、変更した特定のコンポーネントや機能以外にも大きな影響が生じる可能性があります。逸脱には、完全なソリューションのコンテキストでの分析とエンジニアリングが必要です。

RDS からのすべての逸脱は、明確なアクション追跡情報とともに分析され、文書化される必要があります。パートナーには、逸脱をリファレンス設計に合わせる方法を理解するためのデューデリジェンスが求められます。これには、パートナーが Red Hat と連携して、プラットフォームでユースケースがクラス最高の結果を達成できるようにするための関連情報を提供することが必要になる場合があります。これは、ソリューションのサポート可能性と、Red Hat 全体およびパートナーとの整合性を確保するために重要です。

RDS からの逸脱は、次の結果の一部またはすべてを引き起こす可能性があります。

- 問題の解決にはさらに時間がかかる場合があります。

- プロジェクトのサービスレベル契約 (SLA)、プロジェクトの期限、エンドプロバイダーのパフォーマンス要件などが満たされないリスクがあります。

承認されていない逸脱には、経営幹部レベルでのエスカレーションが必要になる場合があります。

注記Red Hat は、パートナーのエンゲージメントの優先順位に基づいて、逸脱のリクエストへの対応を優先します。

3.5. 通信事業者コアの共通ベースラインモデル

以下の設定と使用モデルは、すべての通信事業者コアのユースケースに適用できます。通信事業者コアのユースケースは、この共通の機能ベースラインに基づいて構築します。

- クラスタートポロジー

通信事業者コアリファレンス設計は、次の 2 つの異なるクラスター設定バリアントをサポートしています。

- スケジュール不可能なコントロールプレーン。このバリアントでは、ユーザーワークロードをマスターノード上で実行することが厳密に禁止されています。

スケジュール可能なコントロールプレーン。このバリアントでは、リソース使用率を最適化するために、ユーザーワークロードをマスターノード上で実行することが許可されます。このバリアントはベアメタルコントロールプレーンノードにのみ適用され、インストール時に設定する必要があります。

バリアントに関係なく、すべてのクラスターは次の要件に準拠する必要があります。

- 3 つ以上のノードで構成される可用性の高いコントロールプレーン。

- 複数のマシン設定プールを使用すること。

- ストレージ

- 通信事業者コアのユースケースでは、外部ストレージソリューションによって提供される可用性の高い永続ストレージが必要です。外部ストレージへのアクセスを管理するために OpenShift Data Foundation が使用される場合があります。

- ネットワーク

通信事業者コアクラスターのネットワークは、次の要件に準拠します。

- デュアルスタック IPv4/IPv6 (IPv4 プライマリー)。

- 完全な非接続環境 - クラスターはライフサイクルのどの時点でもパブリックネットワークにアクセスできません。

- 複数のネットワークをサポートします。セグメント化されたネットワークにより、運用、管理および保守 (OAM)、シグナリング、およびストレージトラフィック間の分離を実現します。

- クラスターネットワークタイプは、IPv6 のサポートに必要な OVN-Kubernetes です。

通信事業者コアクラスターには、基盤となる RHCOS、SR-IOV Network Operator、ロードバランサー、およびその他のコンポーネントによってサポートされる複数のネットワークレイヤーがあります。これらのレイヤーには次のものが含まれます。

クラスターネットワークレイヤー。クラスターネットワークの設定は、インストール設定を通じて定義および適用します。NMState Operator を使用して、Day 2 オペレーション中に設定を更新します。初期設定を使用して以下を確立します。

- ホストインターフェイスの設定。

- アクティブ/アクティブボンディング (LACP)。

-

セカンダリー/追加ネットワークレイヤー。ネットワークの

additionalNetworkまたはNetworkAttachmentDefinitionCR を通じて OpenShift Container Platform CNI を設定します。初期設定を使用して、MACVLAN 仮想ネットワークインターフェイスを設定します。 - アプリケーションワークロードレイヤー。ユーザープレーンネットワークは、クラウドネイティブネットワーク機能 (CNF) で実行されます。

- Service Mesh

- 通信事業者 CNF では Service Mesh を使用できます。通信事業者コアクラスターには、通常、Service Mesh の実装が含まれます。実装と設定の選択は、この仕様の範囲外です。

3.6. デプロイ計画

MachineConfigPools (MCP) カスタムリソース (CR) を使用すると、お客様の計画のパラメーターに基づいて、通信事業者コアクラスター内のワーカーノードを別々のノードグループに分割できます。デプロイとアップグレードの時間を最小限に抑えるには、そして何よりもクラスターのアップグレード中に通信事業者グレードのサービスが中断されるの最小限に抑えるには、MCP を使用した慎重なデプロイ計画が欠かせません。

説明

通信事業者コアクラスターは、MachineConfigPools (MCP) を使用して、たとえばハードウェアプロファイルの違いに応じて、ワーカーノードをさらに個別の役割に分割できます。これは各役割のカスタムチューニングを可能にするだけでなく、通信事業者コアクラスターのデプロイやアップグレードを高速化するうえでも重要な役割を果たします。複数の MCP を使用すると、1 つまたは複数のメンテナンス期間にわたってクラスターのアップグレードを適切に計画できます。これは非常に重要です。計画が慎重に策定されていないと、通信事業者グレードのサービスが影響を受ける可能性があるためです。

クラスターをアップグレードする際には、コントロールプレーンのアップグレード中に MCP を一時停止できます。詳細は、「カナリアロールアウト更新の実行」を参照してください。これにより、MCP の一時停止が解除されるまで、ワーカーノードが再起動されず、実行中のワークロードが影響を受けなくなります。

慎重な MCP 計画を使用することで、ノードセットのアップグレードのタイミングと順序をいつでも制御できます。MCP を使用して通信事業者クラスターのアップグレードを計画する方法の詳細は、「更新前にノードに MachineConfigPool ラベルを適用する」を参照してください。

最初のデプロイを開始する前に、MCP に関する次のエンジニアリング上のに関する考慮事項に留意してください。

PerformanceProfile と Tuned プロファイルの関連付け:

PerformanceProfiles を使用する場合は、各 Machine Config Pool (MCP) を 1 つの PerformanceProfile 定義または Tuned プロファイル定義にリンクする必要があることに注意してください。したがって、複数の MCP で必要な設定が同じである場合も、各 MCP に専用の PerformanceProfile 定義が必要です。

MCP のラベル付けストラテジーの計画:

次のような要因に応じて、ワーカーノードを分割するための適切なストラテジーを使用して、MCP のラベル付けを計画してください。

- ワーカーノードのタイプ: 同じハードウェアプロファイルを持つノードのグループを指定します。たとえば、コントロールプレーンのネットワーク機能 (NF) 用のワーカーや、ユーザーデータプレーンの NF 用のワーカーなどです。

- ワーカーノードタイプごとのワーカーノードの数。

- 同じハードウェアプロファイルに必要な MCP の最小数は 1 です。ただし、大規模なクラスターの場合は、それよりも多くなる可能性があります。たとえば、各ステップで影響を受けるクラスター容量の割合を小さくし、よりきめ細かいアップグレードをサポートするために、ハードウェアプロファイルごとに、より多くの MCP を設計することができます。

MCP 内のノードの更新ストラテジーは、アップグレード要件と選択した

maxUnavailable値によって決まります。- 許可されるメンテナンス期間の数。

- メンテナンス期間の長さ。

- ワーカーノードの合計数。

-

MCP に必要な

maxUnavailable(同時に更新されるノードの数)。

以下の点に関連する、ワーカーノードの CNF 要件:

- アップグレード中に必要な Pod ごとの最小可用性。これは Pod Disruption Budget (PDB) を使用して設定します。PDB は、アップグレード中に通信事業者のサービスレベルアグリーメント (SLA) を維持するために不可欠です。PDB の詳細は、「起動している必要がある Pod の数を Pod Disruption Budget を使用して指定する方法について」を参照してください。

- Pod ごとに必要な真の最低限の高可用性。これにより、各レプリカが別々のハードウェア上で稼働するようにします。

- Pod のアフィニティーおよびアンチアフィニティーのリンク: Pod のアフィニティーとアンチアフィニティーの使用方法に関する詳細は、「アフィニティールールとアンチアフィニティールールを使用して、他の Pod を基準にして Pod を配置する」を参照してください。

- アップグレードメンテナンス期間の長さと数。これは通信事業者グレードのサービスに影響を与える可能性があります。

3.7. ゾーン

高可用性 (HA) を確保し、アップグレード時間を短縮するには、複数のノードの同時中断に対応するようにクラスターを設計することが不可欠です。OpenShift Container Platform と Kubernetes は、よく知られたラベル topology.kubernetes.io/zone を使用して、共通の障害ドメインの影響を受けるノードのプールを作成します。トポロジー (アベイラビリティー) ゾーン用にノードにアノテーションを付けることにより、高可用性ワークロードを分散させることができます。その結果、各ゾーンが HA のためにレプリケートされた Pod のセットからレプリカを 1 つだけ保持するようになります。この分散により、1 つのゾーンが失われても HA の制約に違反せず、最小限のサービス可用性が維持されます。OpenShift Container Platform および Kubernetes は、すべてのレプリカ構成要素 (Service、ReplicaSet、StatefulSet、または ReplicationController) に対して、デフォルトの TopologySpreadConstraint を適用します。この制約は、topology.kubernetes.io/zone ラベルに基づいてレプリカを分散させます。このようなデフォルト動作により、ワークロード Pod の仕様を変更することなく、ゾーンベースの分散を適用できます。

通常、クラスターのアップグレードでは、基盤となる OS が更新されるため、ノードの中断が発生します。大規模なクラスターでは、アップグレードを迅速に、できるだけ少ないメンテナンス期間中に完了するために、複数のノードを同時に更新する必要があります。ゾーンを使用して Pod の分散を確実にすることで、(十分な予備容量があれば) 高可用性とサービス可用性を維持しながら、ゾーン内のすべてのノードに同時にアップグレードを適用できます。推奨されるクラスター設計は、前述の考慮事項に基づいてノードを複数の MCP に分割し、1 つの MCP 内のすべてのノードに、他の MCP に割り当てられたゾーンとは区別される単一のゾーンとしてラベル付けすることです。この方法を使用すると、MCP 内のすべてのノードを同時に更新できます。

ライフサイクルフック (readiness、liveness、startup、および pre-stop) は、アプリケーションの可用性を確保するうえで重要な役割を果たします。特にアップグレードの場合、pre-stop フックにより、アプリケーションはノードから退避させられる前に、中断に備えるための必要な手順を実行できます。

- 制限と要件

- デフォルトの TopologySpreadConstraints (TSC) は、明示的な TSC が指定されていない場合にのみ適用されます。Pod に明示的な TSC がある場合は、ゾーンベースの分散を必ず適用してください。

-

クラスターには、MCP の同時更新に耐えられるだけの十分な予備容量が必要です。十分にない場合は、MCP の

maxUnavailableを 100% 未満に設定する必要があります。 - MCP 内のすべてのノードを同時に更新できるかどうかは、さらに、ワークロードの設計と、そのレベルの中断が発生しても要求されるサービスレベルを維持できるかどうかよって決まります。

- エンジニアリングに関する考慮事項

- Pod の drain (Pod の退避) 時間がノードの更新時間に大きな影響を与える可能性があります。Pod の迅速な drain が可能なワークロード設計を確保してください。

高可用性要件を強制するには、PodDisruptionBudgets (PDB) を使用します。

アプリケーションの継続的な可用性を保証するには、クラスター設計で、ワークロードの Pod を分散するのに十分な数の個別のゾーンを使用する必要があります。

- Pod が十分な数のゾーンに分散されている場合、1 つのゾーンが失われても、Pod Disruption Budget (PDB) で許可されているよりも多くの Pod がダウンすることはありません。

- ゾーン数が少なすぎるか、スケジューリング制約が厳しいために Pod が適切に分散されていない場合、ゾーン障害によって PDB 違反が発生し、結果としてサービス停止が発生します。

- さらに、この不十分な分散により、通常は並行して実行されるアップグレードが、PDB 違反を回避するためにゆっくりと順番に (部分的に逐次的に) 実行せざるを得なくなり、メンテナンス時間が大幅に長くなる可能性があります。

- PDB の中断許容 Pod 数が 0 に設定されている場合、ノードの drain がブロックされ、管理者の介入が必要になります。高速かつ自動的なアップグレードの場合は、このパターンを避ける必要があります。

3.8. 通信事業者コアクラスターの共通使用モデルのエンジニアリングに関する考慮事項

- クラスターのワークロードの詳細は、「アプリケーションワークロード」を参照してください。

ワーカーノードは、次のいずれかの CPU で実行する必要があります。

- Intel 第 3 世代 Xeon (IceLake) CPU 以上 (OpenShift Container Platform でサポートされている場合)、またはシリコンセキュリティーバグ (Spectre など) の軽減策が無効になっている CPU。Skylake およびそれ以前の CPU では、Spectre や同様の軽減策を有効にすると、トランザクションパフォーマンスが 40% 低下する可能性があります。

- AMD EPYC Zen 4 CPU (Genoa、Bergamo) または AMD EPYC Zen 5 CPU (Turin) (OpenShift Container Platform でサポートされている場合)。

- Intel Sierra Forest CPU (OpenShift Container Platform でサポートされている場合)。

-

ワーカーノードで IRQ バランシングを有効にします。

PerformanceProfileCR はgloballyDisableIrqLoadBalancingパラメーターの値をfalseに設定します。Guaranteed QoS Pod には、「CPU のパーティショニングとパフォーマンスチューニング」の説明のとおり、分離を実現するためのアノテーションが付けられます。

すべてのクラスターノードが次の条件を満たしている必要があります。

- ハイパースレッディングが有効である

- x86_64 CPU アーキテクチャーを備えている

- 標準の (非リアルタイム) カーネルが有効である

- ワークロードパーティショニング用に設定されていない

クラスター内のマシン設定プールによって、電源管理と最大パフォーマンスのバランスが異なります。マシン設定プールグループ内のすべてのノードで、次の設定が一貫している必要があります。

- クラスターのスケーリング。詳細は、「スケーラビリティー」を参照してください。

- 少なくとも 120 ノードまでクラスターをスケーリングできる必要があります。

-

CPU パーティショニングは

PerformanceProfileCR を使用して設定され、MachineConfigPoolごとにノードに適用されます。「CPU パーティショニングとパフォーマンスチューニング」で関連する考慮事項を参照してください。 設定された機能セットとアプリケーションのワークロード特性によって、OpenShift Container Platform の CPU 要件が異なります。リファレンス設定に基づいて設定されたクラスターの場合、次の CPU 要件が検証済みです。リファレンス設定では、kube-burner ノード密度テストによって作成される 3000 個の Pod からなるシミュレートされたワークロードを実行します。

- コントロールプレーンとワーカーノードの予約済み CPU の最小数は、NUMA ノードあたり 2 CPU (4 ハイパースレッド) です。

- DPDK 以外のネットワークトラフィックに使用する NIC は、最大 32 個の RX/TX キューを使用するように設定する必要があります。

多数の Pod やその他のリソースを持つノードでは、追加の予約済み CPU が必要になる場合があります。残りの CPU はユーザーのワークロードに使用できます。

注記OpenShift Container Platform の設定、ワークロードのサイズ、およびワークロードの特性の変動により、OpenShift プラットフォームに必要な CPU 数にどのような影響があるかを判断するには、追加の分析が必要です。

3.8.1. アプリケーションワークロード

通信事業者コアクラスターで実行されるアプリケーションワークロードには、高パフォーマンスのクラウドネイティブネットワーク機能 (CNF) と従来の Best-effort または Burstable Pod ワークロードが混在している場合があります。

パフォーマンスまたはセキュリティーの要件により CPU を排他的または専用に使用する必要がある Pod では、Guaranteed QoS スケジューリングを利用できます。通常、ユーザープレーンネットワーク (DPDK など) を使用して高パフォーマンス CNF またはレイテンシーの影響を受けやすい CNF を実行する Pod では、ノードのチューニングと Guaranteed QoS スケジューリングによって実現される専用の CPU 全体を排他的に使用する必要があります。専用の CPU を必要とする Pod 設定を作成する場合は、ハイパースレッドシステムの潜在的な影響に注意してください。コア全体 (2 つのハイパースレッド) を Pod に割り当てる必要がある場合、Pod は 2 の倍数の CPU 数を要求する必要があります。

高スループットまたは低レイテンシーのネットワークを必要としないネットワーク機能を実行する Pod は、Best-effort または Burstable QoS Pod を使用してスケジュールする必要があります。専用または分離された CPU コアは必要ありません。

- エンジニアリングに関する考慮事項

次の情報を使用して、通信事業者コアワークロードとクラスターリソースを計画してください。

-

OpenShift Container Platform 4.19 以降、

cgroup v1がサポートされなくなり、削除されました。すべてのワークロードにcgroup v2との互換性がある必要があります。詳細は、Red Hat Enterprise Linux 9 changes in the context of Red Hat OpenShift workloads を参照してください。 - CNF アプリケーションを、最新バージョンの Red Hat Best Practices for Kubernetes に準拠させる必要があります。

アプリケーションの要求に応じて、Best-effort および Burstable QoS Pod を組み合わせて使用します。

-

ノードを設定する

PerformanceProfileCR で予約済みまたは分離された CPU を適切に設定して、Guaranteed QoS Pod を使用します。 - Guaranteed QoS Pod には、CPU を完全に分離するためのアノテーションを含める必要があります。

- Best-effort および Burstable Pod では、CPU の排他的使用が保証されません。ワークロードが、他のワークロード、オペレーティングシステムデーモン、またはカーネルタスクによるプリエンプションの対象になる可能性があります。

-

ノードを設定する

exec プローブは、他に適切な選択肢がない場合にのみ、慎重に使用してください。

-

CNF が CPU ピニングを使用する場合は、exec プローブを使用しないでください。

httpGetやtcpSocketなどの他のプローブ実装を使用します。 - exec プローブを使用する必要がある場合は、exec プローブの頻度と量を制限します。exec プローブの最大数は 10 未満に維持し、頻度は 10 秒以上にする必要があります。

- startup プローブは、安定状態の動作時には大量のリソースを使用しないため、使用できます。exec プローブの制限は、主に liveness および readiness プローブに適用されます。exec プローブはプロセスのフォークを必要とするため、他のプローブタイプと比較して管理コアの CPU 使用率が大幅に高くなります。

-

CNF が CPU ピニングを使用する場合は、exec プローブを使用しないでください。

- アップグレードやノードのメンテナンス中など、Pod が中断される前にアプリケーションワークロードが必要な操作を実行できるようにするには、pre-stop フックを使用します。このフックを使用すると、Pod が状態を永続ストレージに保存したり、サービスからトラフィックをオフロードしたり、他の Pod にシグナルを送信したりできるようになります。

-

OpenShift Container Platform 4.19 以降、

3.8.2. シグナリングワークロード

シグナリングワークロードでは通常、SCTP、REST、gRPC、または同様の TCP プロトコルまたは UDP プロトコルが使用されます。シグナリングワークロードは、MACVLAN または SR-IOV インターフェイスとして設定されたセカンダリー Multus CNI を使用して、数十万のトランザクション毎秒 (TPS) に対応します。このワークロードは、Guaranteed または Burstable のいずれかの QoS を持つ Pod で実行できます。

3.9. 通信事業者コア RDS のコンポーネント

以下のセクションでは、通信事業者コアワークロードを実行するためにクラスターを設定およびデプロイするために使用するさまざまな OpenShift Container Platform コンポーネントと設定を説明します。

3.9.1. CPU パーティショニングとパフォーマンスチューニング

- このリリースの変更点

- RPS の無効化 - Pod ネットワークのリソース使用量をアプリケーション CPU で考慮

- スケジュール可能なコントロールプレーンノード上のコントロールプレーンの分離強化

- NUMA Resources Operator におけるスケジュール可能なコントロールプレーンのサポート

- 通信事業者コアクラスターのアップグレードに関する追加のガイダンス

- 説明

- CPU パーティショニングは、機密性の高いワークロードを、汎用タスク、割り込み、およびドライバー作業キューから分離することで、パフォーマンスを向上させ、レイテンシーを削減します。このような補助的なプロセスに割り当てられた CPU のことを、次のセクションでは 予約済み CPU と呼びます。ハイパースレッディングが有効なシステムでは、CPU は 1 つのハイパースレッドになります。

- 制限と要件

オペレーティングシステムでは、カーネルネットワークを含むすべてのサポートタスクを実行するために、一定量の CPU が必要です。

- ユーザープレーンネットワークアプリケーション (DPDK) のみを備えたシステムでは、オペレーティングシステムとインフラストラクチャーコンポーネント用に、少なくとも 1 つのコア (ハイパースレッディングが有効な場合は 2 つのハイパースレッド) が予約されている必要があります。

- ハイパースレッディングが有効なシステムでは、コアシブリングスレッドが常に同じ CPU プール内にある必要があります。

- 予約済みコアと分離されたコアのセットには、すべての CPU コアが含まれている必要があります。

- 各 NUMA ノードのコア 0 は、予約済み CPU セットに含める必要があります。

- 低レイテンシーのワークロードでは、割り込み、カーネルスケジューラー、またはプラットフォームの他の部分による影響を受けないように特別な設定が必要です。

詳細は、「パフォーマンスプロファイルの作成」を参照してください。

- エンジニアリングに関する考慮事項

-

OpenShift 4.19 以降、

cgroup v1がサポートされなくなり、削除されました。すべてのワークロードにcgroup v2との互換性がある必要があります。詳細は、Red Hat Enterprise Linux 9 changes in the context of Red Hat OpenShift workloads を参照してください。 -

必要な最小予約容量 (

systemReserved) については、Which amount of CPU and memory are recommended to reserve for the system in OCP 4 nodes? のガイダンスに従ってください。 - スケジュール可能なコントロールプレーンの場合、推奨される最小予約容量は少なくとも 16 個の CPU です。

- 実際に必要な予約済み CPU 容量は、クラスターの設定とワークロードの属性によって異なります。

- 予約済み CPU の値は、フルコア (2 ハイパースレッド) に合わせて切り上げる必要があります。

- CPU パーティショニングを変更すると、関連するマシン設定プールに含まれるノードが drain され、再起動されます。

- 予約済み CPU は Pod 密度を低下させます。予約済み CPU は、OpenShift Container Platform ノードの割り当て可能な容量から削除されるためです。

ワークロードがリアルタイム対応である場合は、リアルタイムワークロードヒントを有効にする必要があります。

-

リアルタイム

workloadHint設定を適用すると、nohz_fullカーネルコマンドラインパラメーターが適用され、高パフォーマンスアプリケーションのパフォーマンスが向上します。workloadHint設定を適用すると、cpu-quota.crio.io: "disable"アノテーションと適切なruntimeClassName値を持たない分離された Pod または Burstable Pod が、CRI-O のレート制限の対象となります。workloadHintパラメーターを設定するときは、パフォーマンスの向上と CRI-O のレート制限による潜在的な影響との間のトレードオフに注意してください。必要な Pod にアノテーションが正しく付けられていることを確認してください。

-

リアルタイム

- IRQ アフィニティーをサポートしていないハードウェアは、分離された CPU に影響します。Guaranteed CPU QoS を持つ Pod が割り当てられた CPU を完全に使用できるように、すべてのサーバーハードウェアが IRQ アフィニティーをサポートしている必要があります。

-

OVS が、ネットワークトラフィックのニーズに合わせて、OVS の

cpusetエントリーを動的に管理します。プライマリー CNI で高いネットワークスループットを処理するために、追加の CPU を予約する必要はありません。 - クラスター上で実行されているワークロードがカーネルレベルのネットワークを使用する場合、参加している NIC の RX/TX キュー数を 16 または 32 キューに設定する必要があります (ハードウェアが許す場合)。デフォルトのキュー数に注意してください。設定がない場合、デフォルトのキュー数は、オンラインの CPU ごとに 1 つの RX/TX キューです。この場合、割り当てられる割り込みが多すぎる可能性があります。

コア数の多いシステムでは、irdma カーネルモジュールが原因で、割り込みベクトルの割り当てが多くなりすぎる可能性があります。この状態を防ぐために、リファレンス設定では、

PerformanceProfileリソースのカーネルコマンドライン引数によるこのカーネルモジュールの読み込みを除外します。通常、コアワークロードではこのカーネルモジュールは必要ありません。注記ドライバーによっては、キューの数を減らした後でも、割り込みの割り当てが解除されません。

-

OpenShift 4.19 以降、

3.9.2. スケジュール可能なコントロールプレーン上のワークロード

- コントロールプレーンノードでのワークロードの有効化

スケジュール可能なコントロールプレーンを有効にすると、コントロールプレーンノードでワークロードを実行し、ベアメタルマシン上のアイドル状態の CPU 容量を活用してコストを削減できます。この機能は、ベアメタルコントロールプレーンノードを持つクラスターにのみ適用されます。

この機能には 2 つの異なる要素があります。

- コントロールプレーンノードでのワークロードの許可: この機能は、クラスターの初期インストール後に設定できます。そのため、コントロールプレーンノードでワークロードを実行する必要がある場合に有効にできます。

- ワークロードパーティショニングの有効化: これは、コントロールプレーンを通常のワークロードによる干渉から保護し、クラスターの安定性と信頼性を確保するための重要な分離手段です。ワークロードパーティショニングは、"Day 0" のクラスターの初期インストール時に設定する必要があり、後で有効にすることはできません。

コントロールプレーンノードでワークロードを実行する予定の場合は、まず初期セットアップ時にワークロードパーティショニングを有効にする必要があります。その後、スケジュール可能なコントロールプレーン機能を有効にできます。

- ワークロードの特性と制限

アプリケーションがコアクラスターの機能に干渉しないことを確認するために、ワークロードをテストして検証する必要があります。CPU やネットワークに大きな負荷をかけない軽量のコンテナーから始めることを推奨します。

特定のワークロードは、クラスタの安定性に対するリスクがあるため、コントロールプレーンノード上での実行が許可されていません。これには、カーネル引数またはシステムのグローバル sysctl を再設定するワークロードが含まれます。このようなワークロードにより、クラスターに予期しない結果が生じる可能性があるためです。

安定性を確保するには、以下を遵守する必要があります。

- すべての主要なワークロードに、必ずメモリー制限を定義してください。これにより、メモリーリークが発生した場合もコントロールプレーンが保護されます。

- exec プローブを頻繁に使用するなどして、予約済みの CPU に過度の負荷をかけないようにしてください。

- カーネルベースのネットワークを多用することは避けてください。OVS などのソフトウェアネットワークコンポーネントにより、予約済み CPU の負荷が増加する可能性があるためです。

- NUMA Resources Operator のサポート

- NUMA Resources Operator は、コントロールプレーンノードでの使用がサポートされています。Operator の機能上の動作は変わりません。

3.9.3. Service Mesh

- 説明

- 通信事業者コアのクラウドネイティブ機能 (CNF) には通常、Service Mesh の実装が必要です。具体的な Service Mesh 機能とパフォーマンス要件は、アプリケーションによって異なります。Service Mesh の実装と設定の選択は、このドキュメントの範囲外です。実装では、Pod のネットワークで発生する追加のレイテンシーなど、Service Mesh がクラスターリソースの使用とパフォーマンスに与える影響を考慮する必要があります。

3.9.4. ネットワーク

次の図は、通信事業者コアリファレンス設計のネットワーク設定を示しています。

図3.2 通信事業者コアリファレンス設計のネットワーク設定

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

metallb-system namespace にカスタムの FRRConfiguration CR がある場合は、それを openshift-network-operator namespace に移動する必要があります。

- 説明

- クラスターをデュアルスタック IP (IPv4 と IPv6) 用に設定します。

- 検証済みの物理ネットワーク設定は、2 つのデュアルポート NIC で構成されています。1 つの NIC は、プライマリー CNI (OVN-Kubernetes) と IPVLAN および MACVLAN トラフィック間で共有されます。もう 1 つの NIC は、SR-IOV VF ベースの Pod トラフィック専用です。

-

2 つの NIC ポートがアタッチされたアクティブ/アクティブ IEEE 802.3ad LACP モードで、Linux ボンディングインターフェイス (

bond0) を作成します。トップオブラックネットワーク機器は、マルチシャーシリンクアグリゲーション (mLAG) テクノロジーをサポートし、そのように設定されている必要があります。 -

VLAN インターフェイスは、プライマリー CNI を含め、

bond0の上に作成されます。 -

ボンディングおよび VLAN インターフェイスは、クラスターのインストール時に、インストールのネットワーク設定段階で作成されます。プライマリー CNI によって使用される VLAN (

vlan0) を除き、他のすべての VLAN は、Kubernetes NMstate Operator を使用して Day 2 アクティビティー中に作成できます。 - MACVLAN および IPVLAN インターフェイスは、対応する CNI を使用して作成されます。同じ基本インターフェイスを共有することはありません。詳細は、「Cluster Network Operator」を参照してください。

- SR-IOV VF は SR-IOV Network Operator によって管理されます。

-

LoadBalancer サービスの背後にある Pod のソース IP アドレスの一貫性を確保するために、

EgressIPCR を設定し、podSelectorパラメーターを指定します。EgressIP については、「Cluster Network Operator」セクションでさらに詳しく説明します。 次の手順を実行することで、サービストラフィックの分離を実装できます。

-

NodeNetworkConfigurationPolicyCR を使用して、ノード上の VLAN インターフェイスと特定のカーネル IP ルートを設定します。 -

VLAN ごとに MetalLB

BGPPeerCR を作成して、リモート BGP ルーターとのピアリングを確立します。 -

MetalLB

BGPAdvertisementCR を定義して、選択したBGPPeerリソースのリストにアドバタイズする IP アドレスプールを指定します。次の図は、特定のサービス IP アドレスを、特定の VLAN インターフェイスを介して外部にアドバタイズする方法を示しています。サービスルートは、BGPAdvertisementCR で定義され、IPAddressPool1およびBGPPeer1フィールドの値を使用して設定されます。

-

図3.3 通信事業者コアリファレンス設計の MetalLB サービス分離

3.9.4.1. Cluster Network Operator

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

Cluster Network Operator (CNO) は、クラスターのインストール中に、デフォルトの OVN-Kubernetes ネットワークプラグインを含むクラスターネットワークコンポーネントをデプロイおよび管理します。CNO を使用すると、プライマリーインターフェイスの MTU 設定、Pod の Egress にノードルーティングテーブルを使用するための OVN ゲートウェイモード、および MACVLAN などの追加のセカンダリーネットワークを設定できます。

ネットワークトラフィックの分離をサポートするために、CNO を通じて複数のネットワークインターフェイスが設定されます。これらのインターフェイスへのトラフィックステアリングは、NMState Operator を使用して適用される静的ルートを通じて設定されます。Pod トラフィックが適切にルーティングされるように、OVN-K は

routingViaHostオプションを有効にして設定されます。この設定では、Pod の Egress トラフィックに OVN ではなくカーネルルーティングテーブルと適用された静的ルートを使用します。Whereabouts CNI プラグインは、DHCP サーバーを使用せずに、追加の Pod ネットワークインターフェイスに動的な IPv4 および IPv6 アドレス指定を提供するために使用されます。

- 制限と要件

- IPv6 サポートには OVN-Kubernetes が必要です。

- 大規模 MTU クラスターをサポートするには、接続されたネットワーク機器を同じ値またはそれ以上の値に設定する必要があります。最大 8900 の MTU サイズがサポートされます。

MACVLAN と IPVLAN は、同じ基礎カーネルメカニズム、具体的には

rx_handlerに依存しているため、同じメインインターフェイス上に配置できません。このハンドラーを使用すると、ホストが受信パケットを処理する前にサードパーティーモジュールが受信パケットを処理できるようになります。このようなハンドラーは、ネットワークインターフェイスごとに 1 つだけ登録できます。MACVLAN と IPVLAN は両方とも、機能するために独自のrx_handlerを登録する必要があるため、競合が発生し、同じインターフェイス上で共存することはできません。詳細はソースコードを確認してください。- 代替の NIC 設定としては、共有 NIC を複数の NIC に分割したり、単一のデュアルポート NIC を使用したりすることが考えられます。ただし、これらはテストおよび検証されていません。

- シングルスタック IP 設定のクラスターは検証されていません。

EgressIP

-

EgressIP のフェイルオーバー時間は、

NetworkCR のreachabilityTotalTimeoutSecondsパラメーターによって決まります。このパラメーターは、選択された Egress ノードに到達できないことを検出するために使用されるプローブの頻度を決定します。このパラメーターの推奨値は1秒です。 - EgressIP が複数の Egress ノードで設定されている場合、フェイルオーバー時間が数秒以上になることが予想されます。

- 追加のネットワークインターフェイスを持つノードでは、EgressIP トラフィックは、EgressIP アドレスが割り当てられているインターフェイスを介して送信されます。「Egress IP アドレスの設定」を参照してください。

-

EgressIP のフェイルオーバー時間は、

-

Pod レベルの SR-IOV ボンディングモードを

active-backupに設定し、miimonの値を設定する必要があります (100を推奨)。

- エンジニアリングに関する考慮事項

-

Pod の Egress トラフィックは、

routingViaHostオプションを使用してカーネルルーティングテーブルによって管理されます。ホストに適切な静的ルートを設定する必要があります。

-

Pod の Egress トラフィックは、

3.9.4.2. ロードバランサー

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

metallb-system namespace にカスタムの FRRConfiguration CR がある場合は、それを openshift-network-operator namespace に移動する必要があります。

- 説明

- MetalLB は、標準ルーティングプロトコルを使用するベアメタル Kubernetes クラスターのロードバランサー実装です。これを使用すると、Kubernetes サービスが外部 IP アドレスを取得できます。この IP アドレスは、クラスターのホストネットワークにも追加されます。MetalLB Operator により、クラスターに MetalLB のインスタンスがデプロイされ、そのライフサイクルが管理されます。ユースケースによっては、ステートフルロードバランシングなど、MetalLB では利用できない機能が必要になる場合があります。必要に応じて、外部のサードパーティーロードバランサーを使用できます。外部ロードバランサーの選択と設定は、この仕様の範囲外です。外部のサードパーティーロードバランサーを使用する場合、統合作業の一環として十分な分析を実行し、パフォーマンスとリソース使用率の要件がすべて満たされていることを確認する必要があります。

- 制限と要件

- ステートフルロードバランシングは MetalLB ではサポートされていません。これがワークロード CNF の要件である場合は、代替ロードバランサー実装を使用する必要があります。

- 外部 IP アドレスがクライアントからクラスターのホストネットワークにルーティング可能であることを確認する必要があります。

- エンジニアリングに関する考慮事項

- MetalLB は、通信事業者コア使用モデルでは、BGP モードでのみ使用されます。

-

MetalLB は、通信事業者コア使用モデルでは、ローカルゲートウェイモードで使用される OVN-Kubernetes ネットワークプロバイダーでのみサポートされます。「Cluster Network Operator」の

routingViaHostを参照してください。 MetalLB の BGP 設定は、ネットワークとピアの要件に応じて変化することが予想されます。

- アドレス、アグリゲーション長、自動割り当てなどのバリエーションを使用してアドレスプールを設定できます。

-

MetalLB はルートのアナウンスにのみ BGP を使用します。このモードでは、

transmitIntervalおよびminimumTtlパラメーターのみが関連します。BFD プロファイル内の他のパラメーターは、デフォルトに近い値にしておく必要があります。値を短くすると、検出漏れが発生し、パフォーマンスに影響する可能性があるためです。

3.9.4.3. SR-IOV

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

- SR-IOV を使用すると、Physical Function (PF) を複数の Virtual Function (VF) に分割できます。その後、VF を複数の Pod に割り当てることで、Pod を分離したまま、より高いスループットパフォーマンスを実現できます。SR-IOV Network Operator は、SR-IOV CNI、ネットワークデバイスプラグイン、および SR-IOV スタックのその他のコンポーネントをプロビジョニングおよび管理します。

- 制限と要件

- 特定のネットワークインターフェイスだけがサポートされています。詳細は、「サポートされるデバイス」を参照してください。

- SR-IOV と IOMMU の有効化: SR-IOV Network Operator により、カーネルコマンドラインで IOMMU が自動的に有効化されます。

- SR-IOV VF は PF からリンク状態の更新を受信しません。リンクダウンの検出が必要な場合は、プロトコルレベルで実行する必要があります。

-

MultiNetworkPolicyCR は、netdeviceネットワークにのみ適用できます。これは、vfio インターフェイスを管理できない iptables が実装で使用されるためです。

- エンジニアリングに関する考慮事項

-

vfioモードの SR-IOV インターフェイスは通常、高スループットまたは低レイテンシーを必要とするアプリケーション用に追加のセカンダリーネットワークを有効にするために使用されます。 -

SriovOperatorConfigCR を明示的に作成する必要があります。この CR はリファレンス設定ポリシーに含まれているため、初期デプロイ時に作成されます。 - UEFI セキュアブートまたはカーネルロックダウンを使用したファームウェア更新をサポートしていない NIC は、アプリケーションワークロードに必要な数の Virtual Function (VF) をサポートするために、十分な数の VF を有効にして事前設定する必要があります。Mellanox NIC の場合、SR-IOV Network Operator で Mellanox ベンダープラグインを無効にする必要があります。詳細は、「SR-IOV ネットワークデバイスの設定」を参照してください。

-

Pod の起動後に VF の MTU 値を変更する場合、

SriovNetworkNodePolicyの MTU フィールドを設定しないでください。代わりに、Kubernetes NMState Operator を使用して、関連する PF の MTU を設定してください。

-

3.9.4.4. NMState Operator

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

- Kubernetes NMState Operator は、クラスターノード全体でステートドリブンのネットワーク設定を実行するための Kubernetes API を提供します。これにより、ネットワークインターフェイス設定、静的 IP と DNS、VLAN、トランク、ボンディング、静的ルート、MTU、およびセカンダリーインターフェイスでの無差別モードの有効化が可能になります。クラスターノードは、各ノードのネットワークインターフェイスの状態を API サーバーに定期的に報告します。

- 制限と要件

- 該当なし

- エンジニアリングに関する考慮事項

-

初期ネットワーク設定は、インストール CR の

NMStateConfigコンテンツを使用して適用されます。NMState Operator は、ネットワーク更新に必要な場合にのみ使用されます。 -

SR-IOV の Virtual Function がホストネットワークに使用される場合、NMState Operator (

nodeNetworkConfigurationPolicyCR) を使用して、VLAN や MTU などの VF インターフェイスが設定されます。

-

初期ネットワーク設定は、インストール CR の

3.9.5. ロギング

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

- Cluster Logging Operator を使用すると、リモートアーカイブと分析のために、ノードからログを収集して送信できます。リファレンス設定では、Kafka を使用して監査ログとインフラストラクチャーログをリモートアーカイブに送信します。

- 制限と要件

- 該当なし

- エンジニアリングに関する考慮事項

- クラスターの CPU 使用率の影響は、生成されるログの数またはサイズと、設定されたログフィルタリングの量によって決まります。

- リファレンス設定には、アプリケーションログの送信は含まれていません。設定にアプリケーションログを含めるには、アプリケーションのロギングレートを評価し、予約セットに十分な追加の CPU リソースを割り当てる必要があります。

3.9.6. 電源管理

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

- パフォーマンスプロファイルを使用して、高電力モード、低電力モード、または混合モードでクラスターを設定します。電源モードの選択は、クラスター上で実行しているワークロードの特性、特にレイテンシーに対する敏感さによって異なります。Pod ごとの電源管理 C ステート機能を使用して、低レイテンシー Pod の最大遅延を設定します。

- 制限と要件

- 電源設定は、C ステートや P ステートの有効化など、適切な BIOS 設定に依存します。設定はハードウェアベンダーによって異なります。

- エンジニアリングに関する考慮事項

- レイテンシー: レイテンシーの影響を受けやすいワークロードが要件を満たせるように、高電力設定または Pod ごとの電源管理設定が必要です。Pod ごとの電源管理は、専用のピニングされた CPU を持つ Guaranteed QoS Pod でのみ使用できます。

3.9.7. ストレージ

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

クラウドネイティブのストレージサービスを、OpenShift Data Foundation またはその他のサードパーティーソリューションによって提供できます。

OpenShift Data Foundation は、コンテナー向けの Red Hat Ceph Storage ベースのソフトウェア定義ストレージソリューションです。ブロックストレージ、ファイルシステムストレージ、オンプレミスオブジェクトストレージを提供し、永続的および非永続的なデータ要件の両方に合わせて動的にプロビジョニングできます。通信事業者コアアプリケーションには永続的なストレージが必要です。

注記すべてのストレージデータが転送中に暗号化されるとは限りません。リスクを軽減するには、ストレージネットワークを他のクラスターネットワークから分離します。ストレージネットワークは、他のクラスターネットワークからアクセス可能またはルーティング可能であってはなりません。ストレージネットワークに直接接続されているノードのみがストレージネットワークにアクセスできるようにする必要があります。

3.9.7.1. OpenShift Data Foundation

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

OpenShift Data Foundation は、コンテナー向けのソフトウェア定義ストレージサービスです。OpenShift Data Foundation は、次のどちらかのモードでデプロイできます。

- 内部モード: OpenShift Data Foundation のソフトウェアコンポーネントが、他のコンテナー化されたアプリケーションとともに、OpenShift Container Platform クラスターノード上にソフトウェアコンテナーとして直接デプロイされます。

- 外部モード: OpenShift Data Foundation は専用のストレージクラスター (通常は Red Hat Enterprise Linux (RHEL) 上で実行される別の Red Hat Ceph Storage クラスター) にデプロイされます。

これらのストレージサービスは、アプリケーションワークロードクラスターの外部で実行されます。

通信事業者コアクラスターの場合、ストレージのサポートは、次の理由により、外部モードで実行される OpenShift Data Foundation ストレージサービスによって提供されます。

- OpenShift Container Platform の操作と Ceph の操作間の依存関係を分離することで、OpenShift Container Platform と OpenShift Data Foundation を独立して更新できます。

- 通信事業者コアのユースケースでは、ストレージと OpenShift Container Platform インフラストラクチャー層の操作機能を分離することが、お客様の要件として一般的に求められています。

- 外部の Red Hat Ceph Storage クラスターは、同じリージョンにデプロイされた複数の OpenShift Container Platform クラスターで再利用できます。

OpenShift Data Foundation は、セカンダリー CNI ネットワークを使用したストレージトラフィックの分離をサポートします。

- 制限と要件

- IPv4/IPv6 デュアルスタックネットワーク環境では、OpenShift Data Foundation は IPv4 アドレスを使用します。詳細は、IPv6 サポート を参照してください。

- エンジニアリングに関する考慮事項

- OpenShift Data Foundation ネットワークトラフィックは、VLAN 分離などを使用して、専用ネットワーク上の他のトラフィックから分離する必要があります。

- 十分なスループット、帯域幅、およびパフォーマンス KPI を確保するために、複数の OpenShift Container Platform クラスターを外部の OpenShift Data Foundation クラスターに接続する前に、ワークロード要件のスコープを設定する必要があります。

3.9.7.2. 追加のストレージソリューション

他のストレージソリューションを使用して、通信事業者コアクラスターに永続的なストレージを提供することもできます。このソリューションの設定と統合は、リファレンス設計仕様 (RDS) の範囲外です。

ストレージソリューションを通信事業者コアクラスターに統合する場合は、適切なサイズ設定とパフォーマンス分析を行い、ストレージが全体的なパフォーマンスとリソース使用率の要件を満たしていることを確認する必要があります。

3.9.8. 通信事業者コアデプロイメントのコンポーネント

次のセクションでは、Red Hat Advanced Cluster Management (RHACM) を使用してハブクラスターを設定するために使用するさまざまな OpenShift Container Platform コンポーネントと設定を説明します。

3.9.8.1. Red Hat Advanced Cluster Management

- このリリースの変更点

- ポリシーを管理し、マネージドクラスターにデプロイするには、RHACM と PolicyGenerator CR を使用する方法が推奨されます。これは、この目的のために PolicyGenTemplate CR を使用することに代わる方法です。

- 説明

RHACM は、デプロイされたクラスターに対して、Multi Cluster Engine (MCE) のインストールと継続的な GitOps ZTP ライフサイクル管理を提供します。管理者は、メンテナンス期間中に

Policyカスタムリソース (CR) をクラスターに適用することで、クラスターの設定とアップグレードを宣言的に管理します。管理者は、TALM によって管理される RHACM ポリシーコントローラーを使用してポリシーを適用します。設定、アップグレード、およびクラスターのステータスは、ポリシーコントローラーを通じて管理されます。

マネージドクラスターをインストールすると、RHACM は、カスタムディスクパーティション分割、ロールの割り当て、マシン設定プールへの割り当てをサポートするために、個々のノードにラベルと初期イグニッション設定を適用します。これらの設定は、

SiteConfigまたはClusterInstanceCR を使用して定義します。- 制限と要件

- ハブクラスターのサイズ設定は、クラスターのサイジング で説明されています。

- RHACM のスケーリング制限は、パフォーマンスおよびスケーラビリティー で説明されています。

- エンジニアリングに関する考慮事項

- インストール、サイト、またはデプロイメントごとに固有のコンテンツを持つ複数のクラスターを管理する場合は、RHACM ハブテンプレートを使用することを強く推奨します。RHACM ハブテンプレートを使用すると、インストールごとに固有の値を指定しながら、一貫したポリシーセットをクラスターに適用できます。

3.9.8.2. Topology Aware Lifecycle Manager

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

TALM は、ハブクラスター上でのみ実行される Operator です。TALM は、クラスターや Operator のアップグレード、設定などの変更をネットワーク内のマネージドクラスターにどのようにデプロイするかを管理します。TALM には次のコア機能があります。

- クラスターポリシーの定義に従って、クラスター設定とアップグレード (OpenShift Container Platform および Operator) を順次更新します。

- クラスター更新の遅延適用を提供します。

- ユーザーが設定可能なバッチで、クラスターのセットにポリシー更新を段階的にロールアウトできます。

-

ztp-doneまたは同様のユーザー定義ラベルをクラスターに追加することで、クラスターごとのアクションを実行できます。

- 制限と要件

- 400 個のバッチでクラスターを同時にデプロイできます。

- エンジニアリングに関する考慮事項

-

クラスターの初期インストール中に、TALM によって

ran.openshift.io/ztp-deploy-waveアノテーションが付いたポリシーのみが適用されます。 -

ユーザーが作成した

ClusterGroupUpgradeCR の制御下で、TALM によって任意のポリシーを修正できます。 クラスターアップグレードのメンテナンス期間中に

MachineConfigPool(mcp) CR のpausedフィールドを true に設定し、maxUnavailableフィールドを最大許容値に設定します。これにより、アップグレード中に複数のクラスターノードが再起動されることがなくなり、全体的なアップグレード時間が短縮されます。mcpCR の一時停止を解除すると、すべての設定変更が 1 回の再起動で適用されます。注記インストール中にカスタムの

mcpCR を一時停止し、maxUnavailableを 100% に設定すると、インストール時間を短縮できます。OpenShift Container Platform、Day-2 OLM Operator、カスタム設定を含むアップグレードのオーケストレーションは、これらの更新を記述するポリシーを含む

ClusterGroupUpgrade(CGU) CR を使用して実行できます。- EUS から EUS へのアップグレードは、連鎖した CGU CR を使用してオーケストレーションできます。

- MCP の一時停止の制御は、コントロールプレーンとワーカーノード全体のアップグレードをロールアウトするために、CGU CR のポリシーを通じて管理できます。

-

クラスターの初期インストール中に、TALM によって

3.9.8.3. GitOps Operator および ZTP プラグイン

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

GitOps Operator は、クラスターのデプロイメントと設定を管理するための GitOps 駆動型インフラストラクチャーを提供します。クラスターの定義と設定は Git リポジトリーで管理されます。

ZTP プラグインは、

SiteConfigCR からInstallationCR を生成し、RHACM のPolicyGeneratorCR に基づいてポリシーに設定 CR を自動的にラップすることをサポートします。SiteConfig Operator は、

ClusterInstanceCR からのInstallationCR の生成に対するサポートを強化します。重要クラスターのインストールには、ZTP プラグイン方式を使用した

SiteConfigカスタムリソースよりもClusterInstanceCR を使用する方が推奨されます。必要なすべてのアーティファクト (

SiteConfig、ClusterInstance、PolicyGenerator、PolicyGenTemplate、および補助的なリファレンス CR) を含めて、リリースバージョンに応じて Git リポジトリーを設定する必要があります。これにより、複数のバージョンの OpenShift Container Platform と設定バージョンを、同時に、またアップグレードを通じてクラスターにデプロイして管理できるようになります。Git の構造に関しては、お客様またはパートナーが提供するコンテンツとは別のディレクトリーにリファレンス CR を保管することが推奨されます。これにより、既存のコンテンツを上書きするだけで参照の更新をインポートできます。お客様またはパートナーが提供する CR は、生成された設定ポリシーに簡単に組み込めるように、リファレンス CR と同じ階層のディレクトリーで提供できます。

- 制限と要件

- 各 ArgoCD アプリケーションは最大 1000 個のノードをサポートします。複数の ArgoCD アプリケーションを使用すると、1 つのハブクラスターでサポートされるクラスターの最大数を実現できます。

SiteConfigCR は、参照マニフェストを参照するためにextraManifests.searchPathsフィールドを使用する必要があります。注記OpenShift Container Platform 4.15 以降、

spec.extraManifestPathフィールドは非推奨になりました。

- エンジニアリングに関する考慮事項

クラスターアップグレードのメンテナンス期間中に

MachineConfigPool(MCP) CR のpausedフィールドを true に設定し、maxUnavailableフィールドを最大許容値に設定します。これにより、アップグレード中に複数のクラスターノードが再起動されることがなくなり、全体的なアップグレード時間が短縮されます。mcpCR の一時停止を解除すると、すべての設定変更が 1 回の再起動で適用されます。注記インストール中にカスタムの

MCPCR を一時停止し、maxUnavailableを 100% に設定すると、インストール時間を短縮できます。-

コンテンツを更新するときに混乱や意図しない上書きを避けるために、core-overlay 配下の

reference-crs/ディレクトリー内のカスタム CR と git 内の追加マニフェストには、一意で区別できる名前を使用する必要があります。 -

SiteConfigCR では、複数の追加マニフェストパスが許可されます。複数のディレクトリーパスでファイル名が重複している場合は、ディレクトリー順序リストで最後に見つかったファイルが優先されます。

3.9.9. モニタリング

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

OpenShift Container Platform には Cluster Monitoring Operator (CMO) がデフォルトで含まれています。CMO は、プラットフォームコンポーネントと、必要に応じてユーザープロジェクトのモニタリング (メトリクス、ダッシュボード、アラート) を提供します。管理者は、デフォルトのログ保持期間、カスタムアラートルールなどをカスタマイズできます。

モニタリングスタックの設定は、cluster-monitoring-config ConfigMap 内の単一の文字列値を通じて行われます。このリファレンスチューニングは、以下に示す 2 つの要件の内容を統合したものです。

- Prometheus 設定は、アラートの集約のためにアラートを ACM ハブクラスターに転送するように拡張されています。必要に応じて、この設定を拡張して追加の場所に転送することもできます。

Prometheus の保持期間をデフォルトより短縮します。主要なメトリクスのストレージはクラスターの外部にあることが想定されています。コアクラスター上のメトリクスストレージは、その中央ストアのバックアップとして使用され、またローカルでのトラブルシューティングのために利用可能であることが想定されています。

デフォルト設定に加えて、通信事業者コアクラスターには次のメトリクスが設定されることが予想されます。

- ユーザーワークロードの Pod CPU とメモリーのメトリクスとアラート

- エンジニアリングに関する考慮事項

- Prometheus の保持期間はユーザーによって指定されます。使用される値は、クラスター上の履歴データを維持するための運用要件と、CPU およびストレージリソースとの間のトレードオフです。保持期間が長くなると、ストレージの必要性が高まり、データのインデックス管理に追加の CPU が必要になります。

3.9.10. スケジューリング

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

スケジューラーは、特定のワークロードに対して適切なノードを選択するロールを担う、クラスター全体のコンポーネントです。これはプラットフォームの中核部分であり、一般的なデプロイメントシナリオでは特別な設定は必要ありません。ただし、次のセクションで説明する具体的な使用例はほとんどありません。

NUMA 対応スケジューリングは、NUMA リソース Operator を通じて有効にできます。詳細は、「NUMA 対応ワークロードのスケジューリング」を参照してください。

- 制限と要件

デフォルトのスケジューラーはワークロードの NUMA 局所性を理解しません。ワーカーノード上のすべての空きリソースの合計のみを認識します。これにより、Topology Manager ポリシーが single-numa-node または restricted に設定されているノードにスケジュールされた場合に、ワークロードが拒否される可能性があります。詳細は、「Topology Manager ポリシー」を参照してください。

- たとえば、6 個の CPU を要求し、NUMA ノードごとに 4 個の CPU を持つ空のノードにスケジュールされている Pod を考えてみましょう。ノードの割り当て可能な合計容量は 8 CPU です。スケジューラーは Pod を空のノードに配置します。各 NUMA ノードで使用できる CPU は 4 つしかないため、ノードのローカルアドミッションが失敗します。

-

複数の NUMA ノードを持つすべてのクラスターでは、NUMA Resources Operator を使用する必要があります。詳細は、「NUMA Resources Operator のインストール」を参照してください。NUMA 対応スケジューリングが必要なすべてのノードを選択するには、

KubeletConfigCR のmachineConfigPoolSelectorフィールドを使用します。 - すべてのマシン設定プールに一貫したハードウェア設定を指定する必要があります。たとえば、すべてのノードに同じ NUMA ゾーン数を割り当てることが求められます。

- エンジニアリングに関する考慮事項

- Pod では、正しいスケジュールと分離のためにアノテーションが必要になる場合があります。アノテーションの詳細は、「CPU パーティショニングとパフォーマンスチューニング」を参照してください。

-

SriovNetworkNodePolicyCR の excludeTopology フィールドを使用して、スケジューリング中に SR-IOV Virtual Function NUMA アフィニティーを無視するように設定できます。

3.9.11. ノード設定

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 制限と要件

追加のカーネルモジュールを分析して、CPU 負荷、システムパフォーマンス、KPI を満たす能力への影響を判断してください。

Expand 表3.1 追加のカーネルモジュール 機能 説明 追加のカーネルモジュール

MachineConfigCR を使用して次のカーネルモジュールをインストールし、CNF に拡張カーネル機能を提供します。- sctp

- ip_gre

- nf_tables

- nf_conntrack

- nft_ct

- nft_limit

- nft_log

- nft_nat

- nft_chain_nat

- nf_reject_ipv4

- nf_reject_ipv6

- nfnetlink_log

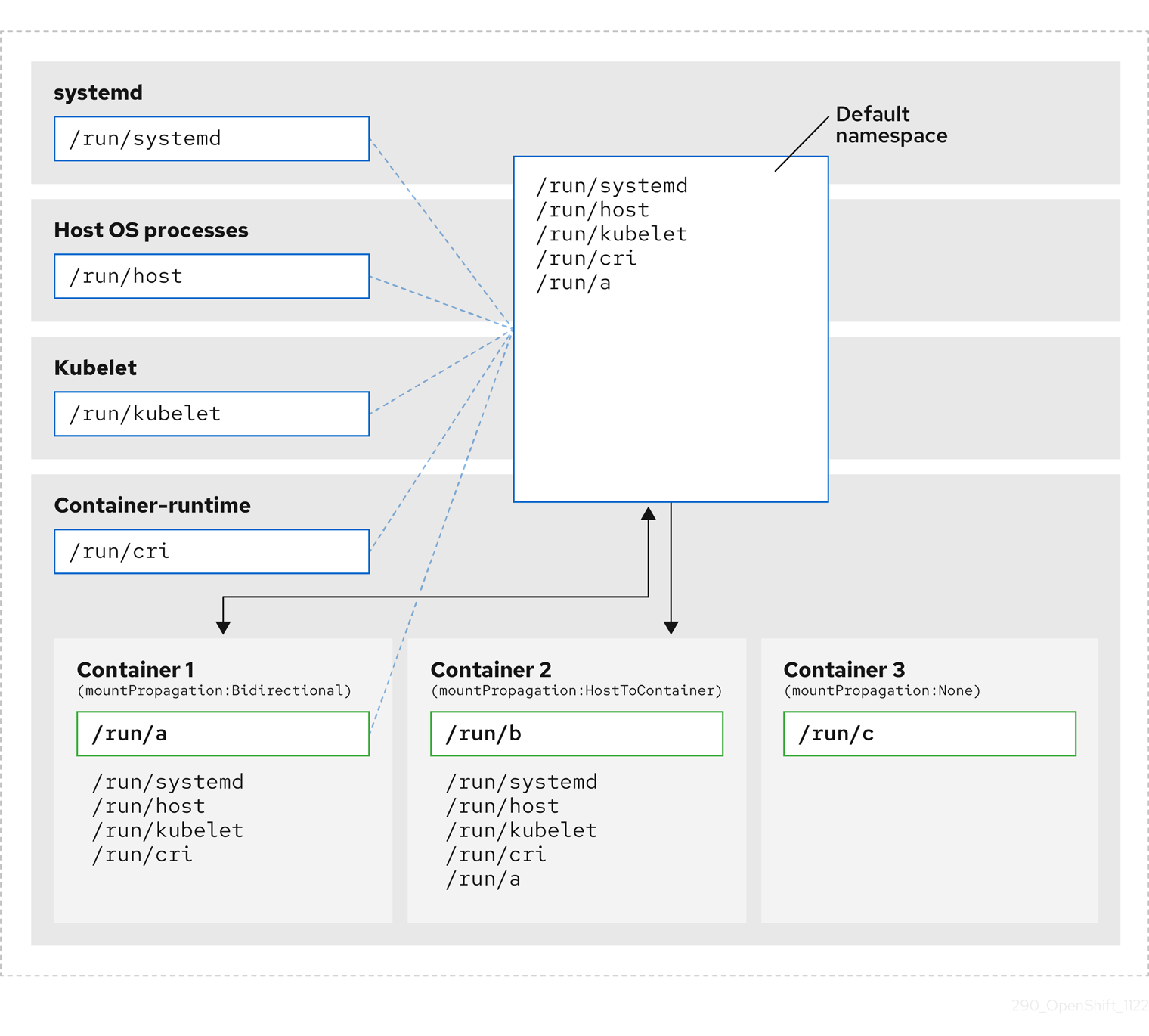

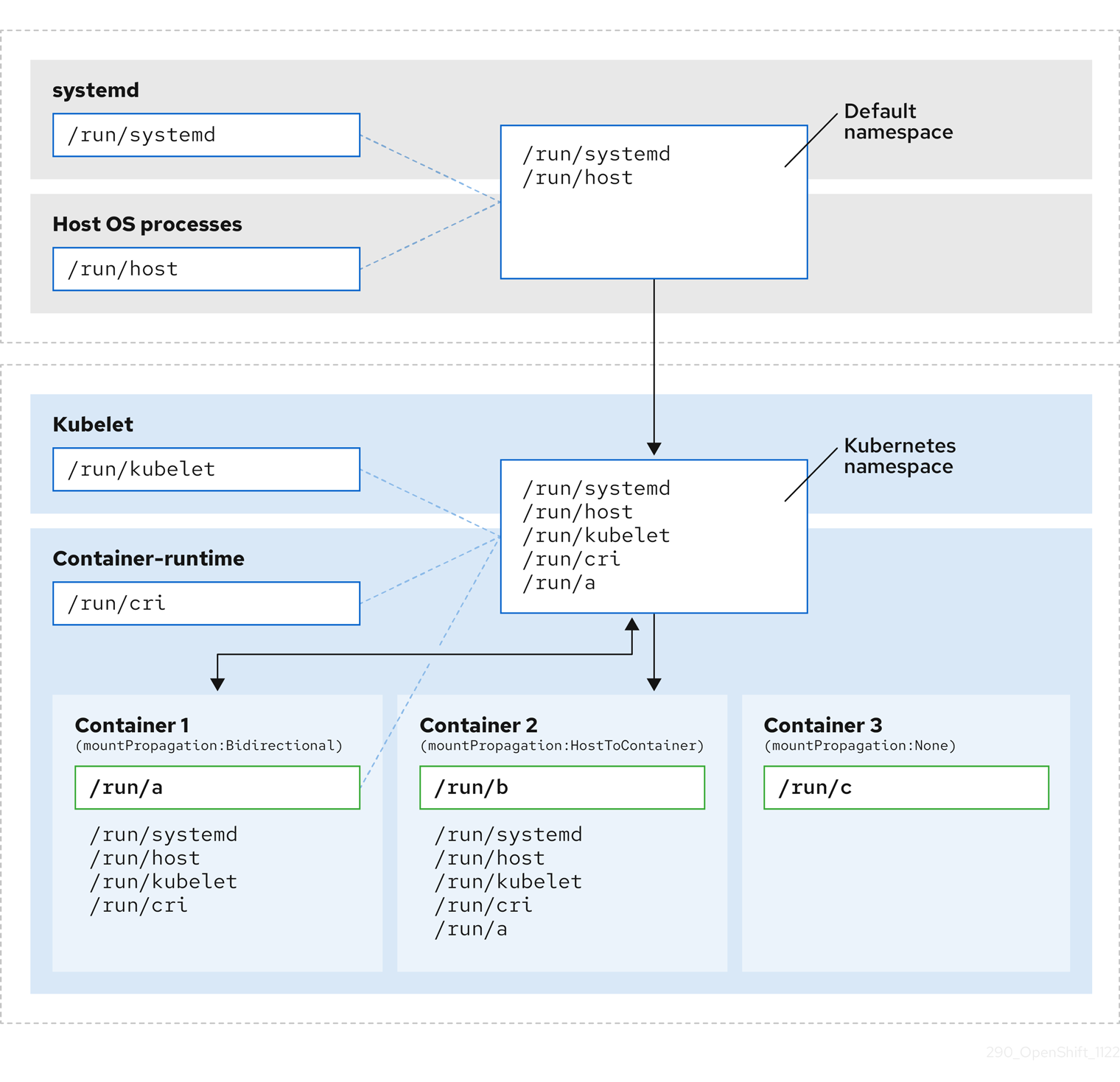

コンテナーマウント namespace の非表示

kubelet のハウスキーピングとエビクションモニタリングの頻度を減らして、CPU 使用量を削減します。kubelet/CRI-O に認識されるコンテナーマウント namespace を作成し、システムマウントスキャンのオーバーヘッドを削減します。

Kdump の有効化

任意の設定 (デフォルトで有効)

3.9.12. ホストファームウェアとブートローダーの設定

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- エンジニアリングに関する考慮事項

推奨される設定は、セキュアブートを有効にすることです。

注記セキュアブートを有効にすると、署名されたカーネルモジュールのみがカーネルによってロードされます。ツリー外のドライバーはサポートされていません。

3.9.13. Kubelet 設定

CNF ワークロードによっては、システム全体の安全な sysctl のリストに含まれていない sysctl を使用するものもあります。通常、ネットワーク関連の sysctl は namespace で分離されており、PerformanceProfile 内の kubeletconfig.experimental アノテーションを allowedUnsafeSysctls という形式の JSON 文字列として使用することで有効にできます。

allowedUnsafeSysctls を示すサンプルスニペット

apiVersion: performance.openshift.io/v2

kind: PerformanceProfile

metadata:

name: {{ .metadata.name }}

annotations:kubeletconfig.experimental: |

{"allowedUnsafeSysctls":["net.ipv6.conf.all.accept_ra"]}

# ...これらは namespace で分離されていますが、Pod がその詳細で指定された制限を超えてメモリーやその他のリソースを消費することを許容する可能性があります。これらの sysctl がプラットフォームリソースを使い果たさないようにする必要があります。

3.9.14. 非接続環境

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

通信事業者コアクラスターは、インターネットに直接アクセスできないネットワークにインストールされることが想定されています。クラスターのインストール、設定、および操作に必要なすべてのコンテナーイメージが、インターネット非接続環境のレジストリーで利用できる必要があります。これには、OpenShift Container Platform イメージ、Day 2 OLM Operator イメージ、アプリケーションワークロードイメージが含まれます。非接続環境を使用すると、次のような複数の利点が得られます。

- セキュリティー - クラスターへのアクセスが制限されます。

- キュレーションされたコンテンツ - クラスター用にキュレーションおよび承認された更新に基づいてレジストリーが作成されます。

- 制限と要件

-

すべてのカスタム

CatalogSourceリソースに一意の名前が必要です。デフォルトのカタログ名を再利用しないでください。

-

すべてのカスタム

- エンジニアリングに関する考慮事項

- クラスターのインストール中に有効なタイムソースを設定する必要があります。

3.9.15. Agent-based Installer

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

通信事業者コアクラスターをインストールする際には、Red Hat Advanced Cluster Management を使用することが推奨されます。Agent Based Installer (ABI) は、OpenShift の独立したインストールフローであり、クラスターをデプロイするための既存のインフラストラクチャーがない環境で使用されます。ABI を使用すると、インストールの管理に追加のサーバーや仮想マシンを必要とせずに、ベアメタルサーバーに OpenShift Container Platform をインストールできます。ただし、継続的なライフサイクル管理、監視、自動化は提供されません。ラップトップなどの任意のシステムで ABI を実行すると、ISO インストールイメージを生成できます。ISO は、クラスターのコントロールプレーンノードのインストールメディアとして使用されます。コントロールプレーンノードの API インターフェイスにネットワーク経由で接続できるシステムであれば、どこからでも ABI を使用して進行状況を監視できます。

ABI は以下をサポートしています。

- 宣言型 CR からのインストール

- 非接続環境でのインストール

- インストールをサポートするために追加のサーバーは必要ありません。たとえば、踏み台ノードは不要です。

- 制限と要件

- 非接続インストールの場合は、必要なすべてのコンテンツがミラーリングされたレジストリーに、インストールされたホストからアクセスできる必要があります。

- エンジニアリングに関する考慮事項

- ネットワーク設定は、NMState Operator を使用した Day 2 設定ではなく、インストール時に NMState 設定として適用する必要があります。

3.9.16. セキュリティー

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

通信事業者のお客様は、セキュリティーを重視しており、複数の攻撃ベクトルに対してクラスターを強化する必要があります。OpenShift Container Platform には、クラスターを保護する単一のコンポーネントや機能はありません。以下では、通信事業者コア RDS で取り上げる使用モデルのさまざまなセキュリティー指向の機能と設定を説明します。

-

SecurityContextConstraints (SCC): すべてのワークロード Pod は、

restricted-v2またはrestrictedSCC を使用して実行する必要があります。 -

Seccomp: すべての Pod は、

RuntimeDefault(またはより強力な) seccomp プロファイルを使用して実行する必要があります。 - ルートレス DPDK Pod: 多くのユーザープレーンネットワーキング (DPDK) CNF では、Pod を root 権限で実行する必要があります。この機能を使用すると、ルート権限がなくても、準拠した DPDK Pod を実行できます。ルートレス DPDK Pod は、ルートレス Pod 内にタップデバイスを作成し、DPDK アプリケーションからカーネルにトラフィックを挿入します。

- ストレージ: ストレージネットワークは分離されており、他のクラスターネットワークにルーティングできないようにする必要があります。詳細は、「ストレージ」セクションを参照してください。

OpenShift Container Platform クラスターノードにカスタムの nftables ファイアウォールルールを実装する場合、サポートされている実装方法について、Red Hat ナレッジベースソリューションの記事 Custom nftable firewall rules in OpenShift Container Platform を参照してください。この記事は、OpenShift Container Platform 環境でネットワークセキュリティーポリシーの管理を担当するクラスター管理者を対象としています。

この方法を導入する前に、次のような運用上の影響を慎重に検討することが重要です。

- 早期適用: ルールは、ネットワークが完全に稼働する前の起動時に適用されます。ルールによって、ブートプロセス中に必要な重要なサービスが誤ってブロックされないように注意してください。

- 設定ミスのリスク: カスタムルールに誤りがあると、意図しない結果が生じ、パフォーマンスに影響が出たり、正当なトラフィックがブロックされたり、ノードが分離される可能性があります。メインクラスターにルールをデプロイする前に、非実稼働環境でルールを十分にテストしてください。

- 外部エンドポイント: OpenShift Container Platform が機能するには、外部エンドポイントへのアクセスが必要です。ファイアウォールの許可リストの詳細は、「OpenShift Container Platform のファイアウォールの設定」を参照してください。クラスターノードが外部エンドポイントにアクセスできることを確認してください。クラスターノードが外部エンドポイントにアクセスできることを確認してください。

ノードの再起動: node disruption policy が設定されていない限り、必要なファイアウォール設定で

MachineConfigCR を適用すると、ノードが再起動します。この影響に注意して、それに応じてメンテナンス期間をスケジュールしてください。詳細は、「node disruption policy を使用してマシン設定の変更による停止を最小限に抑える」を参照してください。注記node disruption policy は、OpenShift Container Platform 4.17 以降で利用できます。

- ネットワークフローマトリックス: Ingress トラフィックの管理の詳細は、「OpenShift Container Platform ネットワークフローマトリックス」を参照してください。Ingress トラフィックを重要なフローに制限して、ネットワークセキュリティーを強化できます。このマトリックスでは、ベースクラスターサービスに関する詳細情報が提供されていますが、Day-2 Operator によって生成されるトラフィックは対象外です。

- クラスターバージョンの更新とアップグレード: OpenShift Container Platform クラスターを更新またはアップグレードするときは注意してください。プラットフォームのファイアウォール要件に適用された最近の変更により、ネットワークポートの権限の調整が必要になる場合があります。ドキュメントにガイドラインが記載されていますが、この要件は今後変化する可能性があることに注意してください。システム停止を最小限に抑えるには、実稼働環境に適用する前に、ステージング環境で更新やアップグレードをテストする必要があります。これにより、ファイアウォール設定の変更に関連する潜在的な互換性の問題を特定して対処できるようになります。

-

SecurityContextConstraints (SCC): すべてのワークロード Pod は、

- 制限と要件

ルートレス DPDK Pod には、次の追加設定が必要です。

-

タッププラグインの

container_tSELinux コンテキストを設定します。 -

クラスターホストの

container_use_devicesSELinux ブール値を有効にします。

-

タッププラグインの

- エンジニアリングに関する考慮事項

-

ルートレス DPDK Pod を使用するには、ホスト上で

container_use_devicesSELinux ブール値を有効にして、タップデバイスの作成を許可します。これにより、許容範囲内のセキュリティーリスクが発生します。

-

ルートレス DPDK Pod を使用するには、ホスト上で

3.9.17. スケーラビリティー

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

- 「制限と要件」の説明に従ってクラスターをスケーリングしてください。ワークロードのスケーリングは、「アプリケーションワークロード」で説明されています。

- 制限と要件

- クラスターは少なくとも 120 ノードまで拡張できます。

3.10. 通信事業者コアリファレンス設定の CR

以下のカスタムリソース (CR) を使用して、通信事業者コアプロファイルを使用して OpenShift Container Platform クラスターを設定およびデプロイします。特に指定がない限り、CR を使用して、すべての特定の使用モデルで使用される共通のベースラインを形成します。

3.10.1. 通信事業者コアリファレンス設計の設定 CR の抽出

telco-core-rds-rhel9 コンテナーイメージから、通信事業者コアプロファイルのカスタムリソース (CR) の完全なセットを抽出できます。コンテナーイメージには、通信事業者コアプロファイルの必須の CR と任意の CR が含まれています。

前提条件

-

podmanをインストールしている。

手順

次のコマンドを実行して、認証情報を使用してコンテナーイメージレジストリーにログオンします。

$ podman login registry.redhat.io次のコマンドを実行して、

telco-core-rds-rhel9コンテナーイメージからコンテンツを抽出します。$ mkdir -p ./out$ podman run -it registry.redhat.io/openshift4/openshift-telco-core-rds-rhel9:v4.19 | base64 -d | tar xv -C out

検証

outディレクトリーのディレクトリー構造は次のとおりです。次のコマンドを実行すると、out/telco-core-rds/ディレクトリー内の通信事業者コア CR を表示できます。$ tree -L 4出力例

. ├── configuration │ ├── compare.sh │ ├── core-baseline.yaml │ ├── core-finish.yaml │ ├── core-overlay.yaml │ ├── core-upgrade.yaml │ ├── kustomization.yaml │ ├── Makefile │ ├── ns.yaml │ ├── README.md │ ├── reference-crs │ │ ├── custom-manifests │ │ │ ├── mcp-worker-1.yaml │ │ │ ├── mcp-worker-2.yaml │ │ │ ├── mcp-worker-3.yaml │ │ │ └── README.md │ │ ├── optional │ │ │ ├── logging │ │ │ ├── networking │ │ │ ├── other │ │ │ └── tuning │ │ └── required │ │ ├── networking │ │ ├── other │ │ ├── performance │ │ ├── scheduling │ │ └── storage │ ├── reference-crs-kube-compare │ │ ├── compare_ignore │ │ ├── comparison-overrides.yaml │ │ ├── metadata.yaml │ │ ├── optional │ │ │ ├── logging │ │ │ ├── networking │ │ │ ├── other │ │ │ └── tuning │ │ ├── ReferenceVersionCheck.yaml │ │ ├── required │ │ │ ├── networking │ │ │ ├── other │ │ │ ├── performance │ │ │ ├── scheduling │ │ │ └── storage │ │ ├── unordered_list.tmpl │ │ └── version_match.tmpl │ └── template-values │ ├── hw-types.yaml │ └── regional.yaml ├── install │ ├── custom-manifests │ │ ├── mcp-worker-1.yaml │ │ ├── mcp-worker-2.yaml │ │ └── mcp-worker-3.yaml │ ├── example-standard.yaml │ ├── extra-manifests │ │ ├── control-plane-load-kernel-modules.yaml │ │ ├── kdump-master.yaml │ │ ├── kdump-worker.yaml │ │ ├── mc_rootless_pods_selinux.yaml │ │ ├── mount_namespace_config_master.yaml │ │ ├── mount_namespace_config_worker.yaml │ │ ├── sctp_module_mc.yaml │ │ └── worker-load-kernel-modules.yaml │ └── README.md └── README.md

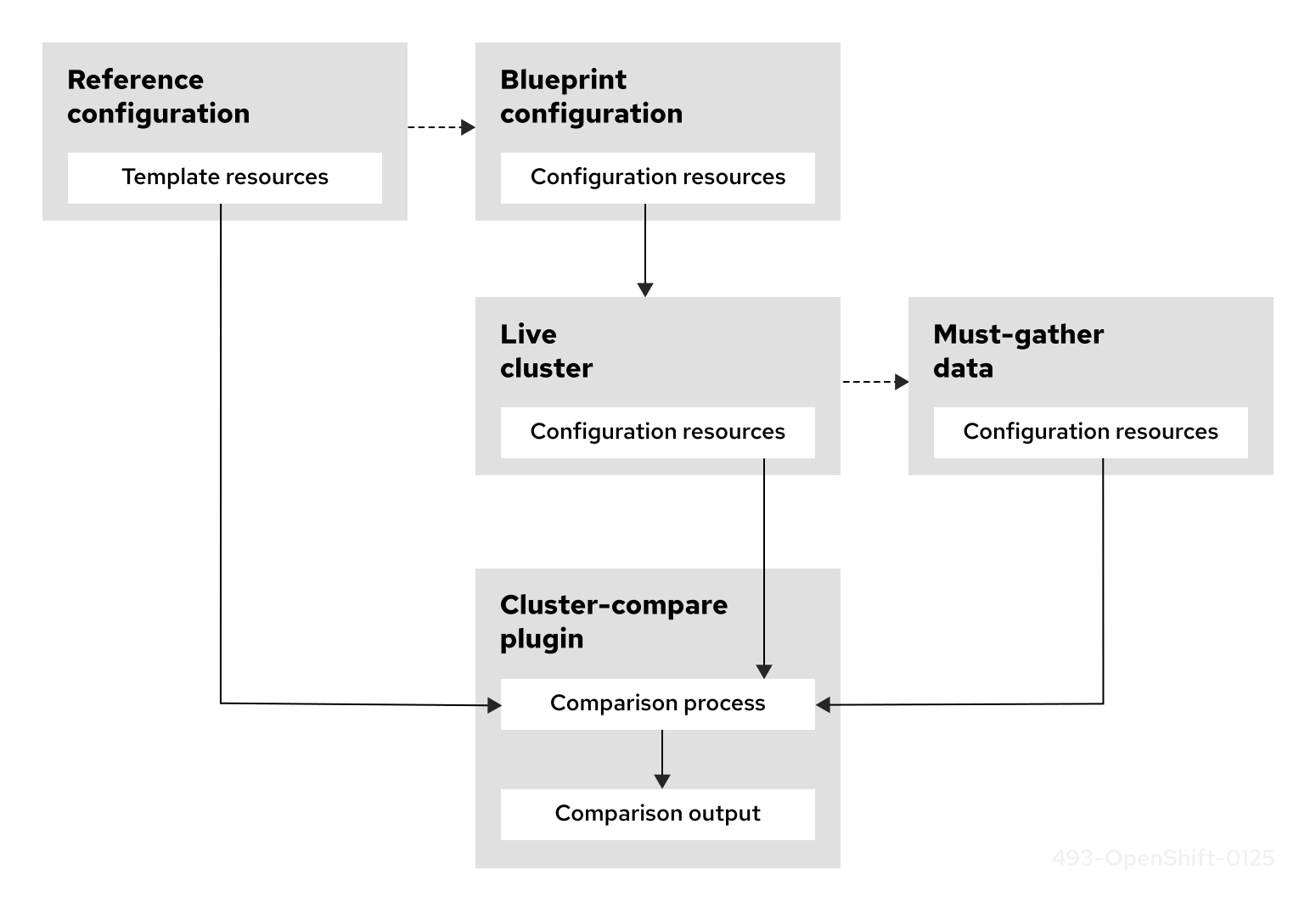

3.10.2. クラスターと通信事業者コアリファレンス設定の比較

通信事業者コアクラスターをデプロイした後、cluster-compare プラグインを使用して、クラスターが通信事業者コアリファレンス設計仕様 (RDS) に準拠しているかどうかを評価できます。cluster-compare プラグインは、OpenShift CLI (oc) のプラグインです。このプラグインは、通信事業者コアリファレンス設定を使用して、通信事業者コアカスタムリソース (CR) を使用するクラスターを検証します。

通信事業者コア用のプラグイン固有のリファレンス設定は、通信事業者コア CR とともにコンテナーイメージにパッケージ化されています。

cluster-compare プラグインの詳細は、「cluster-compare プラグインについて」を参照してください。

前提条件

-

cluster-adminロールを持つユーザーとしてクラスターにアクセスできる。 -

registry.redhat.ioコンテナーイメージレジストリーにアクセスするための認証情報がある。 -

cluster-compareプラグインをインストールした。

手順

次のコマンドを実行して、認証情報を使用してコンテナーイメージレジストリーにログオンします。

$ podman login registry.redhat.io次のコマンドを実行して、

telco-core-rds-rhel9コンテナーイメージからコンテンツを抽出します。$ mkdir -p ./out$ podman run -it registry.redhat.io/openshift4/openshift-telco-core-rds-rhel9:v4.20 | base64 -d | tar xv -C out次のコマンドを実行すると、

out/telco-core-rds/configuration/reference-crs-kube-compareディレクトリー内のリファレンス設定を表示できます。$ tree -L 2出力例

. ├── compare_ignore ├── comparison-overrides.yaml ├── metadata.yaml1 ├── optional2 │ ├── logging │ ├── networking │ ├── other │ └── tuning ├── ReferenceVersionCheck.yaml ├── required3 │ ├── networking │ ├── other │ ├── performance │ ├── scheduling │ └── storage ├── unordered_list.tmpl └── version_match.tmpl次のコマンドを実行して、クラスターの設定を通信事業者コアリファレンス設定と比較します。

$ oc cluster-compare -r out/telco-core-rds/configuration/reference-crs-kube-compare/metadata.yaml出力例

W1212 14:13:06.281590 36629 compare.go:425] Reference Contains Templates With Types (kind) Not Supported By Cluster: BFDProfile, BGPAdvertisement, BGPPeer, ClusterLogForwarder, Community, IPAddressPool, MetalLB, MultiNetworkPolicy, NMState, NUMAResourcesOperator, NUMAResourcesScheduler, NodeNetworkConfigurationPolicy, SriovNetwork, SriovNetworkNodePolicy, SriovOperatorConfig, StorageCluster ... ********************************** Cluster CR: config.openshift.io/v1_OperatorHub_cluster1 Reference File: required/other/operator-hub.yaml2 Diff Output: diff -u -N /tmp/MERGED-2801470219/config-openshift-io-v1_operatorhub_cluster /tmp/LIVE-2569768241/config-openshift-io-v1_operatorhub_cluster --- /tmp/MERGED-2801470219/config-openshift-io-v1_operatorhub_cluster 2024-12-12 14:13:22.898756462 +0000 +++ /tmp/LIVE-2569768241/config-openshift-io-v1_operatorhub_cluster 2024-12-12 14:13:22.898756462 +0000 @@ -1,6 +1,6 @@ apiVersion: config.openshift.io/v1 kind: OperatorHub metadata: + annotations:3 + include.release.openshift.io/hypershift: "true" name: cluster -spec: - disableAllDefaultSources: true ********************************** Summary4 CRs with diffs: 3/45 CRs in reference missing from the cluster: 226 other: other: Missing CRs:7 - optional/other/control-plane-load-kernel-modules.yaml - optional/other/worker-load-kernel-modules.yaml required-networking: networking-root: Missing CRs: - required/networking/nodeNetworkConfigurationPolicy.yaml networking-sriov: Missing CRs: - required/networking/sriov/sriovNetwork.yaml - required/networking/sriov/sriovNetworkNodePolicy.yaml - required/networking/sriov/SriovOperatorConfig.yaml - required/networking/sriov/SriovSubscription.yaml - required/networking/sriov/SriovSubscriptionNS.yaml - required/networking/sriov/SriovSubscriptionOperGroup.yaml required-other: scheduling: Missing CRs: - required/other/catalog-source.yaml - required/other/icsp.yaml required-performance: performance: Missing CRs: - required/performance/PerformanceProfile.yaml required-scheduling: scheduling: Missing CRs: - required/scheduling/nrop.yaml - required/scheduling/NROPSubscription.yaml - required/scheduling/NROPSubscriptionNS.yaml - required/scheduling/NROPSubscriptionOperGroup.yaml - required/scheduling/sched.yaml required-storage: storage-odf: Missing CRs: - required/storage/odf-external/01-rook-ceph-external-cluster-details.secret.yaml - required/storage/odf-external/02-ocs-external-storagecluster.yaml - required/storage/odf-external/odfNS.yaml - required/storage/odf-external/odfOperGroup.yaml - required/storage/odf-external/odfSubscription.yaml No CRs are unmatched to reference CRs8 Metadata Hash: fe41066bac56517be02053d436c815661c9fa35eec5922af25a1be359818f2979 No patched CRs10 - 1

- 比較対象の CR。プラグインにより、対応するテンプレートとの差異のある各 CR が表示されます。

- 2

- 比較対象の CR とマッチするテンプレート。

- 3

- Linux diff 形式の出力に、テンプレートとクラスター CR の差異が表示されます。

- 4

- プラグインにより、各 CR の行の差分が報告されます。その後、差分の概要が報告されます。

- 5

- 対応するテンプレートとの差異を比較した CR の数。

- 6

- リファレンス設定に表されているが、ライブクラスターには存在しない CR の数。

- 7

- リファレンス設定に表されているが、ライブクラスターには存在しない CR のリスト。

- 8

- リファレンス設定内の対応するテンプレートとマッチしなかった CR。

- 9

- メタデータハッシュはリファレンス設定を識別するものです。

- 10

- パッチが適用された CR のリスト。

3.10.3. ノード設定のリファレンス CR

| コンポーネント | リファレンス CR | 説明 | 任意 |

|---|---|---|---|

| 追加のカーネルモジュール |

| オプション。コントロールプレーンノードのカーネルモジュールを設定します。 | いいえ |

| 追加のカーネルモジュール |

| オプション。ワーカーノードに SCTP カーネルモジュールをロードします。 | いいえ |

| 追加のカーネルモジュール |

| オプション。ワーカーノードのカーネルモジュールを設定します。 | いいえ |

| コンテナーマウント namespace の非表示 |

| コントロールプレーンノード上の kubelet と CRI-O 間でコンテナー固有のマウントを共有するためのマウント namespace を設定します。 | いいえ |

| コンテナーマウント namespace の非表示 |

| ワーカーノード上の kubelet と CRI-O 間でコンテナー固有のマウントを共有するためのマウント namespace を設定します。 | いいえ |

| Kdump の有効化 |

| マスターノードで kdump クラッシュレポートを設定します。 | いいえ |

| Kdump の有効化 |

| ワーカーノードで kdump クラッシュレポートを設定します。 | いいえ |

3.10.4. クラスターインフラストラクチャーのリファレンス CR

| コンポーネント | リファレンス CR | 説明 | 任意 |

|---|---|---|---|

| クラスターロギング |

| 指定されたサービスアカウントを使用してログ転送インスタンスを設定し、設定が有効であることを検証します。 | はい |

| クラスターロギング |

| クラスターロギングの namespace を設定します。 | はい |

| クラスターロギング |

| openshift-logging namespace に Operator グループを作成し、Cluster Logging Operator がリソースを監視および管理できるようにします。 | はい |

| クラスターロギング |

| クラスターロギングのサービスアカウントを設定します。 | はい |

| クラスターロギング |

| ログコレクターのサービスアカウントに collect-audit-logs クラスターロールを付与します。 | はい |

| クラスターロギング |

| コレクターのサービスアカウントがインフラストラクチャーリソースからログを収集できるようにします。 | はい |

| クラスターロギング |

| インストールプランの手動承認を使用して、Cluster Logging Operator のサブスクリプションリソースを作成します。 | はい |

| 非接続設定 |

| 非接続環境用の Red Hat Operator カタログを定義します。 | いいえ |

| 非接続設定 |

| 非接続レジストリーのミラーリングされるリポジトリーダイジェストのリストを定義します。 | いいえ |

| 非接続設定 |

| すべてのデフォルトのソースを無効にする OperatorHub 設定を定義します。 | いいえ |

| 監視および可観測性 |

| Prometheus と Alertmanager の保存と保持を設定します。 | はい |

| 電源管理 |

| 選択したノードのパフォーマンスを最適化するために、CPU 分離、huge page 設定、ワークロードヒントを指定して、パフォーマンスプロファイルリソースを定義します。 | いいえ |

3.10.5. リソースチューニングのリファレンス CR

| コンポーネント | リファレンス CR | 説明 | 任意 |

|---|---|---|---|

| システム予約容量 |

| オプション。kubelet を設定して、コントロールプレーンノードプールの予約済みリソースの自動サイズ設定を有効にします。 | はい |

3.10.6. ネットワークのリファレンス CR

| コンポーネント | リファレンス CR | 説明 | 任意 |

|---|---|---|---|

| ベースライン |

| デフォルトのクラスターネットワークを設定して、OVN Kubernetes 設定 (ホスト経由のルーティングなど) を指定します。また、カスタム CNI 設定を含む追加のネットワークの定義と、複数のネットワークを対象としたネットワークポリシーのために MultiNetworkPolicy CR を使用することを可能にします。 | いいえ |

| ベースライン |

| オプション。ノードセレクターや CNI 設定などのネットワーク設定の詳細を指定する NetworkAttachmentDefinition リソースを定義します。 | はい |

| ロードバランサー |

| 指定範囲の IP の動的な割り当ての自動実行を有効にして IP アドレスプールを管理するように MetalLB を設定します。 | いいえ |

| ロードバランサー |

| カスタマイズされた間隔、検出乗数、およびモードを使用して双方向フォワーディング検出 (BFD) を設定し、ネットワーク障害の検出と負荷分散フェイルオーバーを迅速化します。 | いいえ |

| ロードバランサー |

| MetalLB の BGP アドバタイズメントリソースを定義し、IP アドレスプールを BGP ピアにアドバタイズする方法を指定します。これにより、トラフィックのルーティングと通知をきめ細かく制御できるようになります。 | いいえ |

| ロードバランサー |

| 動的ルーティングの BGP ネイバーを表す、MetalLB 内の BGP ピアを定義します。 | いいえ |

| ロードバランサー |

| 名前付きリソースの下に 1 つ以上の BGP コミュニティーをグループ化する MetalLB コミュニティーを定義します。コミュニティーを BGP アドバタイズメントに適用すると、ルーティングポリシーを制御し、トラフィックルーティングを変更できます。 | いいえ |

| ロードバランサー |

| クラスター内の MetalLB リソースを定義します。 | いいえ |

| ロードバランサー |

| クラスター内の metallb-system namespace を定義します。 | いいえ |

| ロードバランサー |

| MetalLB Operator の Operator グループを定義します。 | いいえ |

| ロードバランサー |

| インストールプランの手動承認を使用して、MetalLB Operator のサブスクリプションリソースを作成します。 | いいえ |

| Multus - ルートレス DPDK Pod 用の Tap CNI |

| ワーカーノード上の TAP CNI プラグインに SELinux ブール値を設定する MachineConfig リソースを設定します。 | はい |

| NMState Operator |

| NMState Operator がノードネットワーク設定を管理するために使用する NMState リソースを定義します。 | いいえ |

| NMState Operator |

| NMState Operator の namespace を作成します。 | いいえ |

| NMState Operator |

| openshift-nmstate namespace に Operator グループを作成し、NMState Operator がリソースを監視および管理できるようにします。 | いいえ |

| NMState Operator |

| OLM を通じて管理される NMState Operator のサブスクリプションを作成します。 | いいえ |

| SR-IOV Network Operator |

| ネットワーク機能、IP アドレス管理 (ipam)、および関連するネットワーク namespace およびリソースを指定して SR-IOV ネットワークを定義します。 | いいえ |

| SR-IOV Network Operator |

| デバイス選択、VF の割り当て (numVfs)、ノード固有の設定 (nodeSelector)、優先度のカスタマイズなど、特定ノード上の SR-IOV デバイスのネットワークポリシーを設定します。 | いいえ |

| SR-IOV Network Operator |

| インジェクターと Operator Webhook の有効化、Pod の drain の無効化、設定デーモンのノードセレクターの定義など、SR-IOV Operator のさまざまな設定を指定します。 | いいえ |

| SR-IOV Network Operator |

| OLM を通じて管理される SR-IOV Network Operator のサブスクリプションを作成します。 | いいえ |

| SR-IOV Network Operator |

| SR-IOV Network Operator サブスクリプションの namespace を作成します。 | いいえ |

| SR-IOV Network Operator |

| SR-IOV Network Operator の Operator グループを作成し、Operator がターゲット namespace 内のリソースを監視および管理できるようにします。 | いいえ |

3.10.7. スケジューリングのリファレンス CR

| コンポーネント | リファレンス CR | 説明 | 任意 |

|---|---|---|---|

| NUMA 対応スケジューラー |

| NUMA Resources Operator を有効にして、ワークロードを特定の NUMA ノード設定に合わせて調整します。複数の NUMA ノードを持つクラスターに必要です。 | いいえ |

| NUMA 対応スケジューラー |

| OLM を通じて管理される NUMA Resources Operator のサブスクリプションを作成します。複数の NUMA ノードを持つクラスターに必要です。 | いいえ |

| NUMA 対応スケジューラー |

| NUMA Resources Operator のサブスクリプションの namespace を作成します。複数の NUMA ノードを持つクラスターに必要です。 | いいえ |

| NUMA 対応スケジューラー |

| numaresources-operator namespace に Operator グループを作成し、NUMA Resources Operator がリソースを監視および管理できるようにします。複数の NUMA ノードを持つクラスターに必要です。 | いいえ |

| NUMA 対応スケジューラー |

| ノード全体の Pod の NUMA 対応スケジューリングを処理できる、クラスター内のトポロジー対応スケジューラーを設定します。 | いいえ |

| NUMA 対応スケジューラー |

| ワークロードに対してコントロールプレーンノードをスケジュール対象外として設定します。 | いいえ |

3.10.8. ストレージのリファレンス CR

| コンポーネント | リファレンス CR | 説明 | 任意 |

|---|---|---|---|

| 外部 ODF 設定 |

|

| いいえ |

| 外部 ODF 設定 |

| 外部ストレージバックエンドを使用するようにクラスターを設定する OpenShift Container Storage (OCS) ストレージリソースを定義します。 | いいえ |

| 外部 ODF 設定 |

|

OpenShift Data Foundation Operator の監視対象の | いいえ |

| 外部 ODF 設定 |

|

| いいえ |

3.11. 通信事業者コアリファレンス設定のソフトウェア仕様

Red Hat 通信事業者コア 4.20 ソリューションは、OpenShift Container Platform クラスター用の次の Red Hat ソフトウェア製品を使用して検証されています。

| コンポーネント | ソフトウェアバージョン |

|---|---|

| Red Hat Advanced Cluster Management (RHACM) | 2.14 |

| Red Hat OpenShift GitOps | 1.18 |

| Cluster Logging Operator | 6.2 |

| OpenShift Data Foundation | 4.19 |

| SR-IOV Network Operator | 4.20 |

| MetalLB | 4.20 |

| NMState Operator | 4.20 |

| NUMA 対応スケジューラー | 4.20 |

- Red Hat Advanced Cluster Management (RHACM) は、対応する Red Hat Advanced Cluster Management (RHACM) バージョンがリリースされると、2.15 に更新されます。

- OpenShift Data Foundation は、対応する OpenShift Data Foundation バージョン (4.20) がリリースされると、4.20 に更新されます。

第4章 通信事業者向け RAN DU リファレンス設計仕様

通信事業者 RAN DU リファレンス設計仕様 (RDS) は、無線アクセスネットワーク (RAN) で 5G ワークロードをホストする、コモディティーハードウェア上で実行されるクラスターの設定を表したものです。テスト済みでサポート対象の推奨設定を記録したものであり、通信事業者 RAN DU プロファイルを実行するクラスターで、信頼性が高く再現性のあるパフォーマンスを実現します。

使用モデルとシステムレベルの情報を使用して、マネージドシングルノード OpenShift クラスターの通信事業者 RAN DU ワークロード、クラスターリソース、および最小ハードウェア仕様を計画してください。

個々のコンポーネントの具体的な制限、要件、およびエンジニアリングに関する考慮事項は、それぞれのセクションで説明します。

4.1. 通信事業者 RAN DU 5G デプロイメントのリファレンス設計仕様

Red Hat と認定パートナーは、OpenShift Container Platform 4.20 クラスターで通信事業者アプリケーションを運用するのに必要なネットワークおよび運用機能に関する深い技術的専門知識とサポートを提供します。

Red Hat の通信パートナーは、エンタープライズ 5G ソリューション向けに大規模に複製できる、十分に統合され、十分にテストされた安定した環境を必要としています。通信事業者コアおよび RAN DU リファレンス設計仕様 (RDS) では、OpenShift Container Platform の特定のバージョンに基づいて推奨されるソリューションアーキテクチャーの概要が示されています。各 RDS は、通信事業者コアおよび RAN DU 使用モデル向けにテストおよび検証されたプラットフォーム設定を表したものです。RDS は、通信事業者の 5G コアと RAN DU の重要な KPI セットを定義することで、アプリケーションを実行する際の最適なエクスペリエンスを保証します。RDS に従うことで、重大度の高いエスカレーションが最小限に抑えられ、アプリケーションの安定性が向上します。

5G のユースケースは進化しており、ワークロードは継続的に変化しています。Red Hat は、お客様とパートナーからのフィードバックに基づいて、通信事業者コアと RAN DU RDS を継続的に改善し、要件の変化に対応することに取り組んでいます。

リファレンス設定には、ファーエッジクラスターとハブクラスターコンポーネントの設定が含まれています。

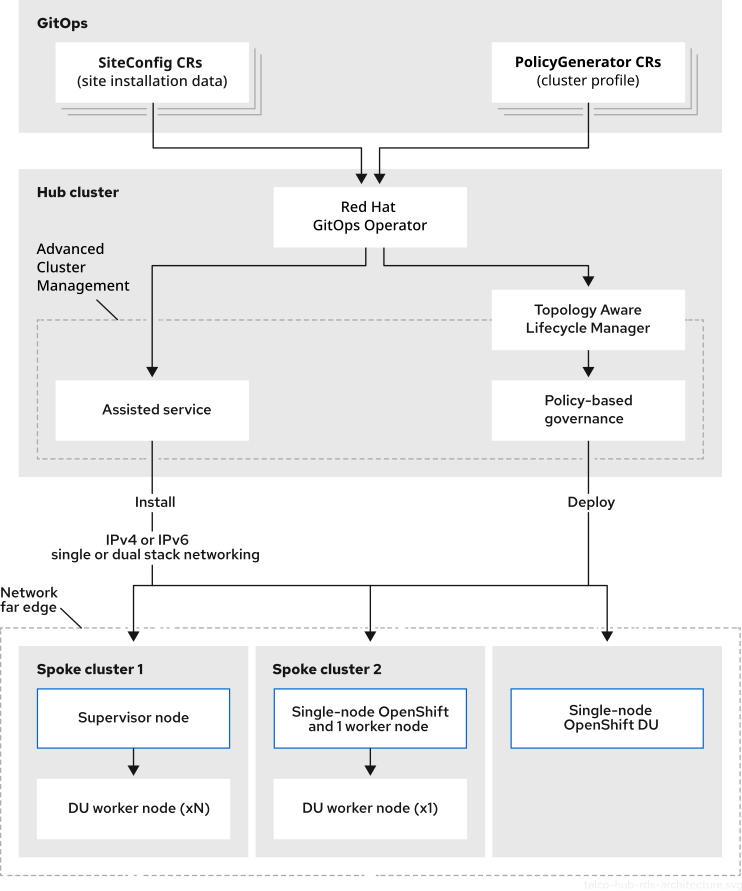

このドキュメントのリファレンス設定は、次の図に示すように、一元的に管理されるハブクラスターインフラストラクチャーを使用してデプロイされます。

図4.1 通信事業者 RAN DU デプロイメントアーキテクチャー

4.1.1. RAN DU でサポートされている CPU アーキテクチャー

| アーキテクチャー | リアルタイムカーネル | 非リアルタイムカーネル |

|---|---|---|

| x86_64 | はい | はい |

| aarch64 | いいえ | はい |

4.2. リファレンス設計の範囲

通信事業者コア、通信事業者 RAN、および通信事業者ハブリファレンス設計仕様 (RDS) は、通信事業者コアおよび通信事業者 RAN プロファイルを実行するクラスターで、信頼性が高く再現性のあるパフォーマンスを実現するために推奨される、テスト済みでサポート対象の設定を表したものです。

各 RDS には、クラスターが個々のプロファイルを実行するために設計および検証された、リリースされた機能とサポートされている設定が含まれています。設定により、機能と KPI ターゲットを満たすベースラインの OpenShift Container Platform インストールが提供されます。各 RDS では、個々の設定ごとに予想される変動も説明します。各 RDS の検証には、長期間にわたる大規模なテストが多数含まれます。

検証済みのリファレンス設定は、OpenShift Container Platform のメジャー Y-stream リリースごとに更新されます。Z-stream パッチリリースは、リファレンス設定に照らして定期的に再テストされます。

4.3. リファレンス設計からの逸脱

検証済みの通信事業者コア、通信事業者 RAN DU、および通信事業者ハブリファレンス設計仕様 (RDS) から逸脱すると、変更した特定のコンポーネントや機能以外にも大きな影響が生じる可能性があります。逸脱には、完全なソリューションのコンテキストでの分析とエンジニアリングが必要です。

RDS からのすべての逸脱は、明確なアクション追跡情報とともに分析され、文書化される必要があります。パートナーには、逸脱をリファレンス設計に合わせる方法を理解するためのデューデリジェンスが求められます。これには、パートナーが Red Hat と連携して、プラットフォームでユースケースがクラス最高の結果を達成できるようにするための関連情報を提供することが必要になる場合があります。これは、ソリューションのサポート可能性と、Red Hat 全体およびパートナーとの整合性を確保するために重要です。

RDS からの逸脱は、次の結果の一部またはすべてを引き起こす可能性があります。

- 問題の解決にはさらに時間がかかる場合があります。

- プロジェクトのサービスレベル契約 (SLA)、プロジェクトの期限、エンドプロバイダーのパフォーマンス要件などが満たされないリスクがあります。

承認されていない逸脱には、経営幹部レベルでのエスカレーションが必要になる場合があります。

注記Red Hat は、パートナーのエンゲージメントの優先順位に基づいて、逸脱のリクエストへの対応を優先します。

4.4. RAN DU 使用モデルのエンジニアリングに関する考慮事項

RAN DU 使用モデルは、RAN 分散ユニット (DU) ワークロードをホストする、コモディティーハードウェア上で実行される OpenShift Container Platform クラスターを設定するものです。モデルおよびシステムレベルの考慮事項は、以下で説明します。個々のコンポーネントの具体的な制限、要件、およびエンジニアリングに関する考慮事項は、後のセクションで詳しく説明します。

telco RAN DU RDS KPI テスト結果の詳細は、telco RAN DU 4.20 リファレンス設計仕様 KPI テスト結果を 参照してください。この情報は顧客とパートナーのみが利用できます。

- クラスタートポロジー

RAN DU ワークロードに推奨されるトポロジーは、シングルノードの OpenShift です。DU ワークロードは、必要に応じて、3 ノードコンパクトクラスター、高可用性 (3 つのコントロールプレーン + n 個のワーカーノード)、SNO+1 など、他のクラスタートポロジーでも実行できます。SNO+1 トポロジーよりも、複数の SNO クラスター、または可用性の高い 3 ノードコンパクトクラスターが推奨されます。

標準のクラスタートポロジーの場合 (3+n)、混合アーキテクチャークラスターは次の場合にのみ許可されます。

- すべてのコントロールプレーンノードが x86_64 である。

- すべてのワーカーノードが aarch64 である。

リモートワーカーノード (RWN) クラスタートポロジーは、このリファレンス設計仕様では推奨されておらず、設計仕様の対象外です。RWN は、RAN DU などのサービスレベルアグリーメント要件が厳しいワークロードにとって次の欠点があるため、検討対象から除外されています。

- イメージベースのアップグレードと、その機能によって提供される高速アップグレードやロールバック機能などのメリットがサポートされていない。

- Day 2 Operator への更新がすべての RWN に同時に影響し、ローリング更新を実行することができない。

- コントロールプレーンの損失 (障害シナリオ) が発生すると、コントロールプレーンによってサービスが提供されるサイトの数が多いため、全体的なサービスの可用性に非常に大きな影響が及ぶ。

- 監視猶予期間および toleration のタイムアウトを超える期間にわたり、RWN とコントロールプレーン間のネットワーク接続が失われると、Pod のエビクションが発生し、サービス停止につながる可能性がある。

- コンテナーイメージの事前キャッシュがサポートされていない。

- ワークロードアフィニティーの複雑さの増大。

- RAN DU でサポートされているクラスタートポロジー

Expand 表4.2 RAN DU でサポートされているクラスタートポロジー アーキテクチャー SNO SNO+1 3 ノード Standard RWN x86_64

はい

はい

はい

はい

いいえ

aarch64

はい

いいえ

いいえ

いいえ

いいえ

mixed

該当なし

いいえ

いいえ

はい

いいえ

- ワークロード

- DU ワークロードは、通信事業者 RAN DU アプリケーションワークロード で説明されています。

- DU ワーカーノードは、最大のパフォーマンスが得られるようにチューニングされたホストファームウェアを備えた Intel 第 3 世代 Xeon (IceLake) 2.20 GHz 以上です。

- リソース

- システム内で実行中の Pod の最大数 (アプリケーションワークロードと OpenShift Container Platform Pod を含む) は 160 です。

- リソース使用量

OpenShift Container Platform のリソース使用量は、以下のアプリケーションワークロードの特性など、さまざまな要因によって異なります。

- Pod 数

- プローブの種類と頻度

- カーネルネットワークを使用したプライマリーまたはセカンダリー CNI のメッセージングレート

- API アクセスレート

- ロギングレート

- ストレージ IOPS

リソース使用量は、次のように設定されたクラスターを対象に測定されます。

- クラスターは、シングルノードの OpenShift がインストールされた 1 台のホストです。

- クラスターは、「リファレンスアプリケーションワークロードの特性」で説明されている代表的なアプリケーションワークロードを実行します。

- クラスターは、「ハブクラスター管理の特性」で詳述されている制約下で管理されます。

- 使用モデル設定で "任意" と記載されているコンポーネントは対象外です。

注記これらの基準を満たさない RAN DU RDS の範囲外の設定では、リソース使用量と KPI 目標の達成能力への影響を判断するために、追加の分析が必要です。これらの要件を満たすには、追加のクラスターリソースを割り当てる必要がある場合があります。

- リファレンスアプリケーションワークロードの特性

- vRAN アプリケーション (管理および制御機能を含む) 用に、5 つの namespace にわたって 75 個の Pod と、Pod あたり 4 つのコンテナーを使用します。

-

namespace ごとに 30 個の

ConfigMapCR と 30 個のSecretCR を作成します。 - exec プローブは使用しません。

セカンダリーネットワークを使用します。

注記プラットフォームメトリクスから CPU 負荷を抽出できます。以下に例を示します。

$ query=avg_over_time(pod:container_cpu_usage:sum{namespace="openshift-kube-apiserver"}[30m])- アプリケーションログは、プラットフォームのログコレクターによって収集されません。

- プライマリー CNI の総トラフィックは最大 30 Mbps、セカンダリーネットワークでは最大 5 Gbps です。

- ハブクラスター管理の特性

RHACM は推奨されるクラスター管理ソリューションであり、次の制限に従って設定されています。

- 最大 10 個の RHACM 設定ポリシーを使用します。これは、Red Hat が提供する 5 個のポリシーと、準拠評価間隔が 10 分以上の最大 5 個のカスタム設定ポリシーで構成されます。

- クラスターポリシーで、最小限の数 (最大 10 個) のマネージドクラスターテンプレートを使用します。ハブ側のテンプレーティングを使用します。

-

policyControllerを除いて RHACM アドオンを無効にし、デフォルト設定で可観測性を設定します。

次の表に、リファレンスアプリケーションの負荷時のリソース使用量を示します。

Expand 表4.3 リファレンスアプリケーションの負荷時のリソース使用量 メトリクス 制限 注記 OpenShift プラットフォームの CPU 使用量

4000 mc 未満 - 2 コア (4HT)

プラットフォームの CPU は、各予約済みコアの両方のハイパースレッドを含む予約済みコアにピニングされます。このシステムは、定期的なシステムタスクとスパイクに対応できるように、安定状態で 3 つの CPU (3000 mc) を使用するように設計されています。

OpenShift プラットフォームのメモリー

16 G 未満

4.5. 通信事業者 RAN DU アプリケーションワークロード

次の要件と制限に準拠した RAN DU アプリケーションを開発します。

- 説明と制限

- 最新バージョンの Red Hat best practices for Kubernetes に準拠したクラウドネイティブネットワーク機能 (CNF) を開発します。

- 高性能ネットワークには SR-IOV を使用します。

exec プローブは、他に適切な選択肢がない場合にのみ、慎重に使用してください。

-

CNF が CPU ピニングを使用する場合は、exec プローブを使用しないでください。

httpGetやtcpSocketなどの他のプローブ実装を使用します。 exec プローブを使用する必要がある場合は、exec プローブの頻度と量を制限します。exec プローブの最大数は 10 未満に維持し、頻度は 10 秒以上にする必要があります。exec プローブはプロセスのフォークを必要とするため、他のプローブタイプと比較して管理コアの CPU 使用率が大幅に高くなります。

注記起動プローブは、定常状態の動作中に最小限のリソースしか必要としません。exec プローブの制限は、主に liveness および readiness プローブに適用されます。

-

CNF が CPU ピニングを使用する場合は、exec プローブを使用しないでください。

注記この仕様で説明されているリファレンス DU アプリケーションワークロードのディメンションに準拠するテストワークロードは、openshift-kni/du-test-workloads にあります。

4.6. 通信事業者 RAN DU リファレンス設計のコンポーネント

以下のセクションでは、RAN DU ワークロードを実行するためにクラスターを設定およびデプロイするのに使用するさまざまな OpenShift Container Platform コンポーネントと設定を説明します。

図4.2 通信事業者 RAN DU リファレンス設計のコンポーネント

通信事業者 RAN DU プロファイルで指定されていない追加コンポーネントが、ワークロードアプリケーションに割り当てられた CPU リソースに影響を与えないことを確認してください。

ツリー外のドライバーはサポートされていません。5G RAN アプリケーションコンポーネントは、RAN DU プロファイルに含まれておらず、アプリケーションに割り当てられたリソース (CPU) に合わせて設計する必要があります。

4.6.1. ホストファームウェアのチューニング

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明

初期クラスターデプロイメント中に最適なパフォーマンスが得られるようにホストファームウェア設定を調整します。詳細は、「vDU アプリケーションのワークロードに推奨されるシングルノード OpenShift クラスター設定」を参照してください。初期デプロイ時にホストファームウェアにチューニング設定を適用します。詳細は、「GitOps ZTP によるホストファームウェア設定の管理」を参照してください。マネージドクラスターホストのファームウェア設定は、ハブクラスターで個別の

BareMetalHostカスタムリソース (CR) として使用できます。この CR は、ClusterInstanceCR と GitOps ZTP を使用してマネージドクラスターをデプロイするときに作成されます。注記ClusterInstanceCR は、指定のリファレンス CRexample-sno.yamlに基づいて作成してください。- 制限と要件

- ホストファームウェア設定でハイパースレッディングを有効にする必要があります。

- エンジニアリングに関する考慮事項

- パフォーマンスを最大限に高めるために、すべてのファームウェア設定を調整します。

- 省電力用に調整されていない限り、すべての設定は最大のパフォーマンスが得られるものと予想されます。

- 必要に応じて、省電力用にパフォーマンスを犠牲にしてホストファームウェアを調整できます。

- Secure Boot を有効にします。セキュアブートを有効にすると、署名されたカーネルモジュールのみがカーネルによってロードされます。ツリー外のドライバーはサポートされていません。

4.6.2. Kubelet 設定

CNF ワークロードによっては、システム全体の安全な sysctl のリストに含まれていない sysctl を使用するものもあります。通常、ネットワーク関連の sysctl は namespace で分離されており、PerformanceProfile カスタムリソース (CR) の kubeletconfig.experimental アノテーションを次の形式の JSON 文字列として使用することで有効にできます。

allowedUnsafeSysctls を示すサンプルスニペット

apiVersion: performance.openshift.io/v2

kind: PerformanceProfile

metadata:

name: {{ .metadata.name }}

annotations:kubeletconfig.experimental: |

{"allowedUnsafeSysctls":["net.ipv6.conf.all.accept_ra"]}

# ...これらの sysctl は namespace で分離されていますが、Pod がその詳細で指定された制限を超えてメモリーやその他のリソースを消費することを許容する可能性があります。これらの sysctl がプラットフォームリソースを使い果たさないようにする必要があります。

詳細は、「コンテナーでの sysctl の使用」を参照してください。

4.6.3. CPU パーティショニングとパフォーマンスチューニング

- このリリースの変更点

PerformanceProfileおよびTunedPerformancePatchオブジェクトが更新され、aarch64 アーキテクチャーを完全にサポートするようになりました。-

以前に

TunedPerformancePatchオブジェクトに追加のパッチを適用していた場合は、それらのパッチを、代わりにran-du-performanceプロファイルを含む新しいパフォーマンスプロファイルに変換する必要があります。「エンジニアリングに関する考慮事項」セクションを参照してください。

-

以前に

- 説明

-

RAN DU 使用モデルには、低遅延パフォーマンスを実現する

PerformanceProfileCR を使用したクラスターパフォーマンスチューニングと、RAN 固有の追加のチューニングを追加するTunedPerformancePatchCR が含まれます。リファレンスPerformanceProfileは、x86_64 および aarch64 CPU アーキテクチャー用のものが提供されています。提供される単一のTunedPerformancePatchオブジェクトが、CPU アーキテクチャーを自動的に検出し、必要となる追加のチューニングを実行します。RAN DU ユースケースでは、低レイテンシーのパフォーマンスを実現するためにクラスターをチューニングする必要があります。PerformanceProfileおよびTunedPerformancePatchCR は、Node Tuning Operator によってリコンサイルされます。

PerformanceProfile CR を使用したノードのチューニングの詳細は、「パフォーマンスプロファイルを使用した低レイテンシーを実現するためのノードのチューニング」を参照してください。

- 制限と要件

通信事業者 RAN DU プロファイルの

PerformanceProfileCR で次の設定を設定する必要があります。次のいずれかの CPU に対して、4 つ以上の予約済み

cpusetを設定します。これは、x86_64 では 4 ハイパースレッド (2 コア)、aarch64 では 4 コアに相当します。- 最大のパフォーマンスが得られるようにチューニングされたホストファームウェアを備えた Intel 第 3 世代 Xeon (IceLake) 2.20 GHz 以上の CPU

- AMD EPYC Zen 4 CPU (Genoa、Bergamo)

ARM CPU (Neoverse)

注記パフォーマンスへの潜在的な影響を判断するために、Pod ごとの電源管理などの機能を評価することを推奨します。

x86_64:

-

予約済み

cpusetを設定し、含まれる各コアの両方のハイパースレッドシブリングを含めます。予約されていないコアは、ワークロードのスケジュールに割り当て可能な CPU として使用できます。 - ハイパースレッドシブリングが予約済みコアと分離されたコアに分割されていないことを確認します。

- 予約済みおよび分離された CPU に、CPU 内の全コアの全スレッドが含まれていることを確認します。

- 予約済み CPU セットに各 NUMA ノードの Core 0 を含めます。

- huge page のサイズを 1G に設定します。

-

予約済み

aarch64:

- 予約済み CPU セットに最初の 4 つのコア (またはそれ以上) を使用します。

- huge page のサイズを 512M に設定します。

- デフォルトで管理ワークロードパーティションの一部として設定されている OpenShift Container Platform Pod のみを予約済みコアにピニングします。

-

ハードウェアベンダーから推奨されている場合は、

hardwareTuningセクションを使用して、予約済み CPU と分離された CPU の最大 CPU 周波数を設定します。

- エンジニアリングに関する考慮事項

RealTime (RT) カーネル

x86_64 では、最大限のパフォーマンスメトリクスを達成するには、RT カーネルを使用する必要があります。これは

x86_64/PerformanceProfile.yaml設定のデフォルトです。- 必要に応じて、パフォーマンスに相応の影響が及びますが、非 RT カーネルを選択することもできます。

-

aarch64 では、RAN DU ユースケースには 64k ページサイズの非 RT カーネルのみが推奨されます。これは

aarch64/PerformanceProfile.yaml設定のデフォルトです。

- 設定する huge page の数は、アプリケーションのワークロード要件によって異なります。このパラメーターの変動は予想され、許容されます。

- 選択したハードウェアとシステムで使用されている追加コンポーネントに基づいて、予約済みおよび分離された CPU セットの設定が変更されることが予想されます。この変更が指定の制限を満たしている必要があります。

- IRQ アフィニティーをサポートしていないハードウェアは、分離された CPU に影響します。CPU 全体が保証される QoS を持つ Pod で、割り当てられた CPU を最大限に活用できるようにするには、サーバー内のすべてのハードウェアが IRQ アフィニティーをサポートしている必要があります。

-

ワークロードパーティショニングを有効にするには、デプロイ時に

cpuPartitioningModeをAllNodesに設定し、PerformanceProfileCR を使用して、オペレーティングシステム、割り込み、および OpenShift Container Platform Pod をサポートするのに十分な CPU を割り当てます。 -

x86_64 では、

PerformanceProfileCR にvfio_pci用の追加のカーネル引数設定が含まれています。この引数は、FEC アクセラレーターなどのデバイスをサポートするために含まれています。ワークロードに必要ない場合には除外できます。 aarch64 では、プラットフォームのニーズに応じて

PerformanceProfileを調整する必要があります。Grace Hopper システムの場合、次のカーネルコマンドライン引数が必要です。

-

acpi_power_meter.force_cap_on=y -

module_blacklist=nouveau -

pci=realloc=off -

pci=pcie_bus_safe

-

-

その他の ARM プラットフォームでは、

iommu.passthrough=1またはpci=reallocを有効にする必要がある場合があります。

TunedPerformancePatch.yamlの拡張と補強:-

TunedPerformancePatch.yamlは、ran-du-performanceという名前のデフォルトの最上位 tuned プロファイルと、ran-du-performance-architecture-commonという名前のアーキテクチャー対応の RAN チューニングプロファイル、および共通ポリシーによって自動的に選択されるアーキテクチャー固有の追加の子ポリシーを導入します。 -

デフォルトでは、

ran-du-performanceプロファイルは、priorityレベル18に設定されており、PerformanceProfile によって作成されたプロファイルopenshift-node-performance-openshift-node-performance-profileとran-du-performance-architecture-commonの両方を含んでいます。 PerformanceProfileオブジェクトの名前をカスタマイズした場合は、PerformanceProfileCR によって作成された tuned プロファイルの名前変更と、ran-du-performance-architecture-commonRAN チューニングプロファイルを含む新しい tuned オブジェクトを作成する必要があります。priorityは 18 未満である必要があります。たとえば、PerformanceProfile オブジェクトの名前がchange-this-nameの場合、次のようにします。apiVersion: tuned.openshift.io/v1 kind: Tuned metadata: name: custom-performance-profile-override namespace: openshift-cluster-node-tuning-operator spec: profile: - name: custom-performance-profile-x data: | [main] summary=Override of the default ran-du performance tuning to adjust for our renamed PerformanceProfile include=openshift-node-performance-change-this-name,ran-du-performance-architecture-common recommend: - machineConfigLabels: machineconfiguration.openshift.io/role: "master" priority: 15 profile: custom-performance-profile-x-

さらにオーバーライドする場合は、オプションの

TunedPowerCustom.yaml設定ファイルに、提供されるTunedPerformancePatch.yamlをオーバーレイしたり直接編集したりせずに拡張する方法が例示されています。追加の tuned プロファイルを作成し、そのプロファイルにran-du-performanceという名前の最上位 tuned プロファイルを含めて、recommendセクションでより小さなpriorityの数値を指定することで、設定を簡単に追加できます。 - Node Tuning Operator の詳細は、「Node Tuning Operator の使用」を参照してください。

-

4.6.4. PTP Operator

- このリリースの変更点

- このリリースではリファレンス設計の更新はありません。

- 説明