虚拟化

OpenShift Virtualization 安装、使用和发行注记

摘要

第 1 章 关于

1.1. 关于 OpenShift virtualization

OpenShift Virtualization 的功能与支持范围。

1.1.1. OpenShift Virtualization 的作用

OpenShift 虚拟化(OpenShift virtualization)是 OpenShift Container Platform 的一个附加组件,可用于运行和管理虚拟机工作负载以及容器工作负载。

OpenShift Virtualization 通过 Kubernetes 自定义资源添加新对象至 OpenShift Container Platform 集群中,以启用虚拟化任务。这些任务包括:

- 创建和管理 Linux 和 Windows 虚拟机 (VM)

- 在集群中运行 pod 和虚拟机工作负载

- 通过各种控制台和 CLI 工具连接至虚拟机

- 导入和克隆现有虚拟机

- 管理虚拟机上附加的网络接口控制器和存储磁盘

- 在节点间实时迁移虚拟机

增强版 web 控制台提供了一个图形化的门户界面 来管理虚拟化资源以及 OpenShift Container Platform 集群容器和基础架构。

OpenShift Virtualization 的设计和测试,可与 Red Hat OpenShift Data Foundation 功能配合工作。

使用 OpenShift Data Foundation 部署 OpenShift Virtualization 时,您必须为 Windows 虚拟机磁盘创建一个专用存储类。详情请参阅为 Windows 虚拟机优化 ODF PersistentVolume。

您可以将 OpenShift Virtualization 与 OVN-Kubernetes、OpenShift SDN 或 认证的 OpenShift CNI 插件 中列出的其他认证网络插件一起使用。

您可以通过安装 Compliance Operator 并运行带有 ocp4-moderate 和 ocp4-moderate-node 配置集的扫描来检查您的 OpenShift Virtualization 集群的合规性。Compliance Operator 使用 NIST 认证工具 OpenSCAP 扫描并执行安全策略。

1.1.1.1. OpenShift Virtualization 支持的集群版本

支持在 OpenShift Container Platform 4.16 集群中使用 OpenShift Virtualization 4.16。要使用 OpenShift Virtualization 的最新 z-stream 版本,您必须首先升级到 OpenShift Container Platform 的最新版本。

1.1.2. 关于虚拟机磁盘的卷和访问模式

如果您将存储 API 与已知的存储供应商搭配使用,则会自动选择卷和访问模式。但是,如果您使用没有存储配置集的存储类,您必须配置卷和访问模式。

要获得最佳结果,请使用 ReadWriteMany (RWX)访问模式和 Block 卷模式。这一点非常重要:

-

实时迁移需要

ReadWriteMany(RWX) 访问模式。 块卷模式的性能优于Filesystem卷模式。这是因为Filesystem卷模式使用更多存储层,包括文件系统层和磁盘镜像文件。虚拟机磁盘存储不需要这些层。例如,如果您使用 Red Hat OpenShift Data Foundation,Ceph RBD 卷优先于 CephFS 卷。

您不能使用以下配置实时迁移虚拟机:

-

具有

ReadWriteOnce(RWO) 访问模式的存储卷 - 透传功能,比如 GPU

对于这些虚拟机,将 evictionStrategy 字段设置为 None。None 策略会在节点重启过程中关闭虚拟机。

1.1.3. 单节点 Openshift 的不同

您可以在单节点 OpenShift 上安装 OpenShift Virtualization。

但是,您应该注意单节点 OpenShift 不支持以下功能:

- 高可用性

- Pod 中断预算

- 实时迁移

- 配置了驱除策略的虚拟机或模板

1.1.4. 其他资源

1.2. 安全策略

了解 OpenShift Virtualization 安全和授权。

关键点

-

OpenShift Virtualization 遵循

restrictedKubernetes pod 安全标准配置集,旨在强制实施 Pod 安全性的当前最佳实践。 - 虚拟机 (VM) 工作负载作为非特权 pod 运行。

-

为

kubevirt-controller服务帐户定义 安全性上下文约束 (SCC)。 - OpenShift Virtualization 组件的 TLS 证书都会被更新并自动轮转。

1.2.1. 关于工作负载安全性

默认情况下,虚拟机 (VM) 工作负载不会在 OpenShift Virtualization 中使用 root 权限运行,且不支持的 OpenShift Virtualization 功能需要 root 权限。

对于每个虚拟机,virt-launcher pod 以 会话模式运行一个 libvirt 实例,用于管理虚拟机进程。在会话模式中,libvirt 守护进程以非 root 用户帐户运行,仅允许同一用户标识符 (UID) 下运行的客户端的连接。因此,虚拟机作为非特权 pod 运行,遵循最小特权的安全原则。

1.2.2. TLS 证书

OpenShift Virtualization 组件的 TLS 证书都会被更新并自动轮转。您不需要手动刷新它们。

自动续订计划

TLS 证书会根据以下调度自动删除并替换:

- kubeVirt 证书每天都会被更新。

- 容器化数据导入程序控制器(CDI)证书每 15 天更新一次。

- MAC 池证书会每年续订。

自动 TLS 证书轮转不会破坏任何操作。例如,以下操作可在没有任何中断的情况下继续工作:

- 迁移

- 镜像上传

- VNC 和控制台连接

1.2.3. 授权

OpenShift Virtualization 使用基于角色的访问控制 (RBAC )为人类用户和服务帐户定义权限。为服务帐户定义的权限控制 OpenShift Virtualization 组件可以执行的操作。

您还可以使用 RBAC 角色管理用户对虚拟化功能的访问。例如,管理员可以创建一个 RBAC 角色,它提供启动虚拟机所需的权限。然后,管理员可以通过将角色绑定到特定用户来限制访问权限。

1.2.3.1. OpenShift Virtualization 的默认集群角色

通过使用集群角色聚合,OpenShift Virtualization 会扩展默认的 OpenShift Container Platform 集群角色,使其包含访问虚拟化对象的权限。

| 默认集群角色 | OpenShift Virtualization 集群角色 | OpenShift Virtualization 集群角色描述 |

|---|---|---|

|

|

| 此用户可以查看集群中的所有 OpenShift Virtualization 资源,但不能创建、删除、修改或访问它们。例如,用户可以看到虚拟机 (VM) 正在运行,但不能将其关闭或访问其控制台。 |

|

|

| 可以修改集群中的所有 OpenShift Virtualization 资源的用户。例如,用户可以创建虚拟机、访问虚拟机控制台和删除虚拟机。 |

|

|

|

具有所有 OpenShift Virtualization 资源的完整权限的用户,包括删除资源集合。用户也可以查看和修改 OpenShift Virtualization 运行时配置,该配置位于 |

1.2.3.2. OpenShift Virtualization 中存储功能的 RBAC 角色

为 Containerized Data Importer (CDI) 授予以下权限,包括 cdi-operator 和 cdi-controller 服务帐户。

1.2.3.2.1. 集群范围的 RBAC 角色

| CDI 集群角色 | Resources | Verbs |

|---|---|---|

|

|

|

|

|

|

| |

|

|

|

|

|

|

| |

|

|

|

|

|

|

| |

|

|

|

|

| API 组 | Resources | Verbs |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

允许列表: |

|

|

|

允许列表: |

|

|

|

|

|

| API 组 | Resources | Verbs |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1.2.3.2.2. 命名空间的 RBAC 角色

| API 组 | Resources | Verbs |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| API 组 | Resources | Verbs |

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

1.2.3.3. kubevirt-controller 服务帐户的额外 SCC 和权限

Pod 的安全上下文约束(SCC)控制权限。这些权限包括 Pod(容器集合)可以执行的操作以及它们可以访问的资源。您可以使用 SCC 定义 Pod 运行必须满足的一组条件,以便其能被系统接受。

virt-controller 是一个集群控制器,可为集群中的虚拟机创建 virt-launcher pod。这些 pod 由 kubevirt-controller 服务帐户授予权限。

kubevirt-controller 服务帐户被授予额外的 SCC 和 Linux 功能,以便能够创建具有适当权限的 virt-launcher Pod。这些扩展权限允许虚拟机使用超出典型 pod 范围的 OpenShift Virtualization 功能。

kubevirt-controller 服务帐户被授予以下 SCC:

-

scc.AllowHostDirVolumePlugin = true

这允许虚拟机使用 hostpath 卷插件。 -

scc.AllowPrivilegedContainer = false

可确保 virt-launcher pod 不是作为特权容器运行。 scc.AllowedCapabilities = []corev1.Capability{"SYS_NICE", "NET_BIND_SERVICE"}-

SYS_NICE允许设置 CPU 关联性。 -

NET_BIND_SERVICE允许 DHCP 和 Slirp 操作。

-

查看 kubevirt-controller 的 SCC 和 RBAC 定义

您可以使用 oc 工具查看 kubevirt-controller 的 SecurityContextConstraints 定义:

$ oc get scc kubevirt-controller -o yaml

您可以使用 oc 工具查看 kubevirt-controller clusterrole 的 RBAC 定义:

$ oc get clusterrole kubevirt-controller -o yaml

1.2.4. 其他资源

1.3. OpenShift Virtualization 架构

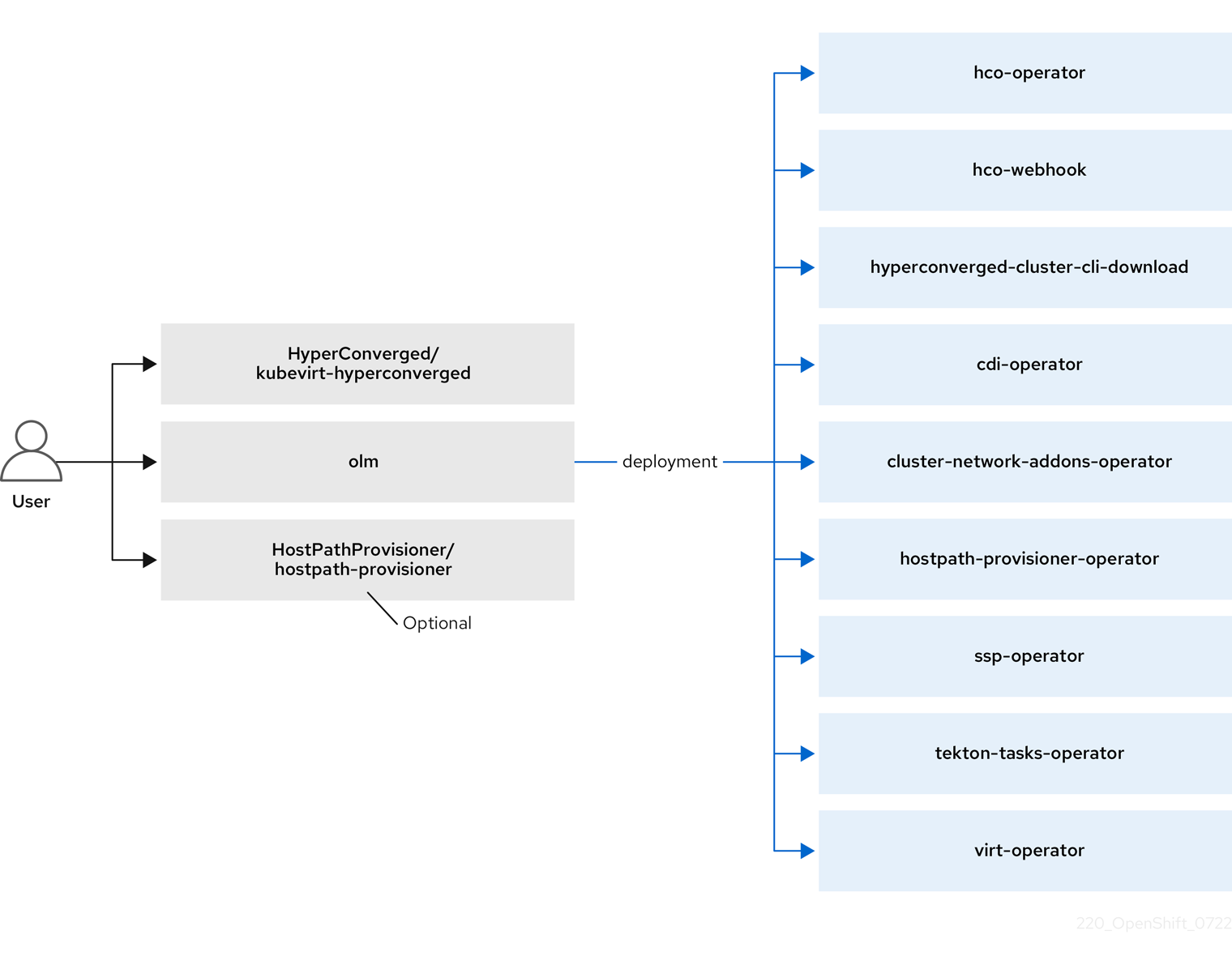

Operator Lifecycle Manager (OLM) 为 OpenShift Virtualization 的每个组件部署 Operator pod:

-

Compute:

virt-operator -

Storage:

cdi-operator -

Network:

cluster-network-addons-operator -

Scaling:

ssp-operator

OLM 还会部署 hyperconverged-cluster-operator pod,它负责其他组件的部署、配置和生命周期,以及几个 helper pod: hco-webhook 和 hyperconverged-cluster-cli-download。

成功部署所有 Operator pod 后,您应该创建 HyperConverged 自定义资源 (CR)。HyperConverged CR 中的配置充当 OpenShift Virtualization 的单个来源,并指导 CR 的行为。

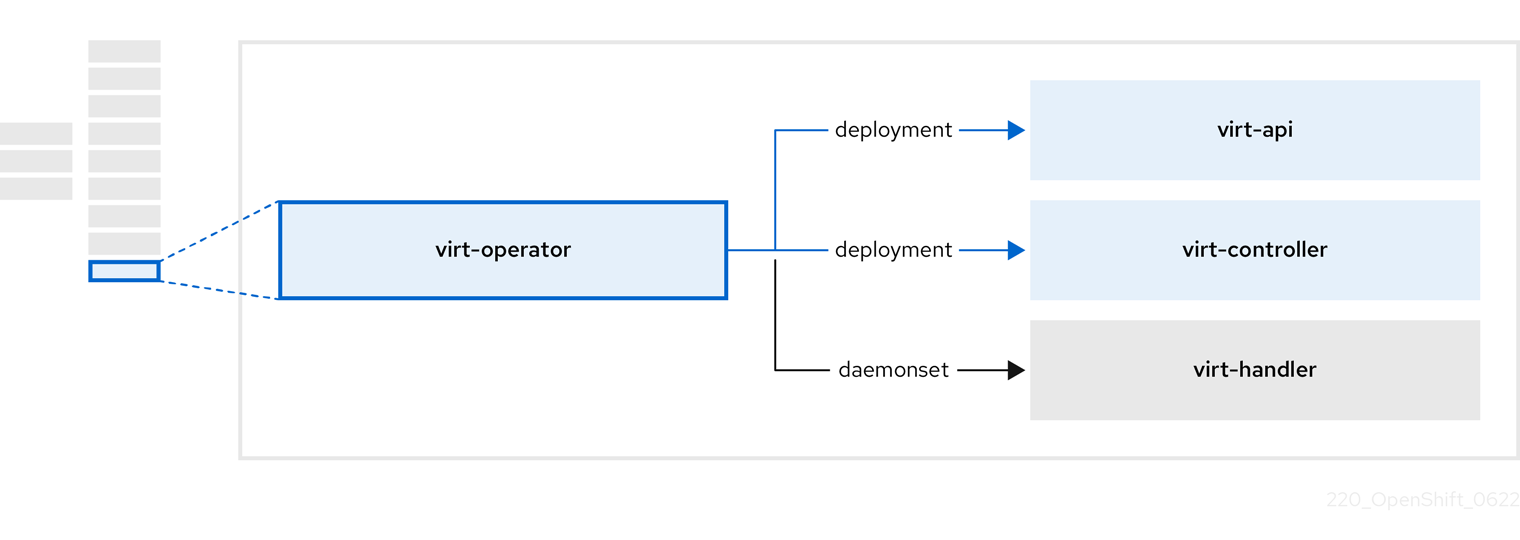

HyperConverged CR 为其协调循环中的所有其他组件的 operator 创建对应的 CR。然后,每个 Operator 会为 OpenShift Virtualization control plane 创建资源,如守护进程集、配置映射和其他组件。例如,当 HyperConverged Operator (HCO) 创建 KubeVirt CR 时,OpenShift Virtualization Operator 会协调它并创建其他资源,如 virt-controller、virt-handler 和 virt-api。

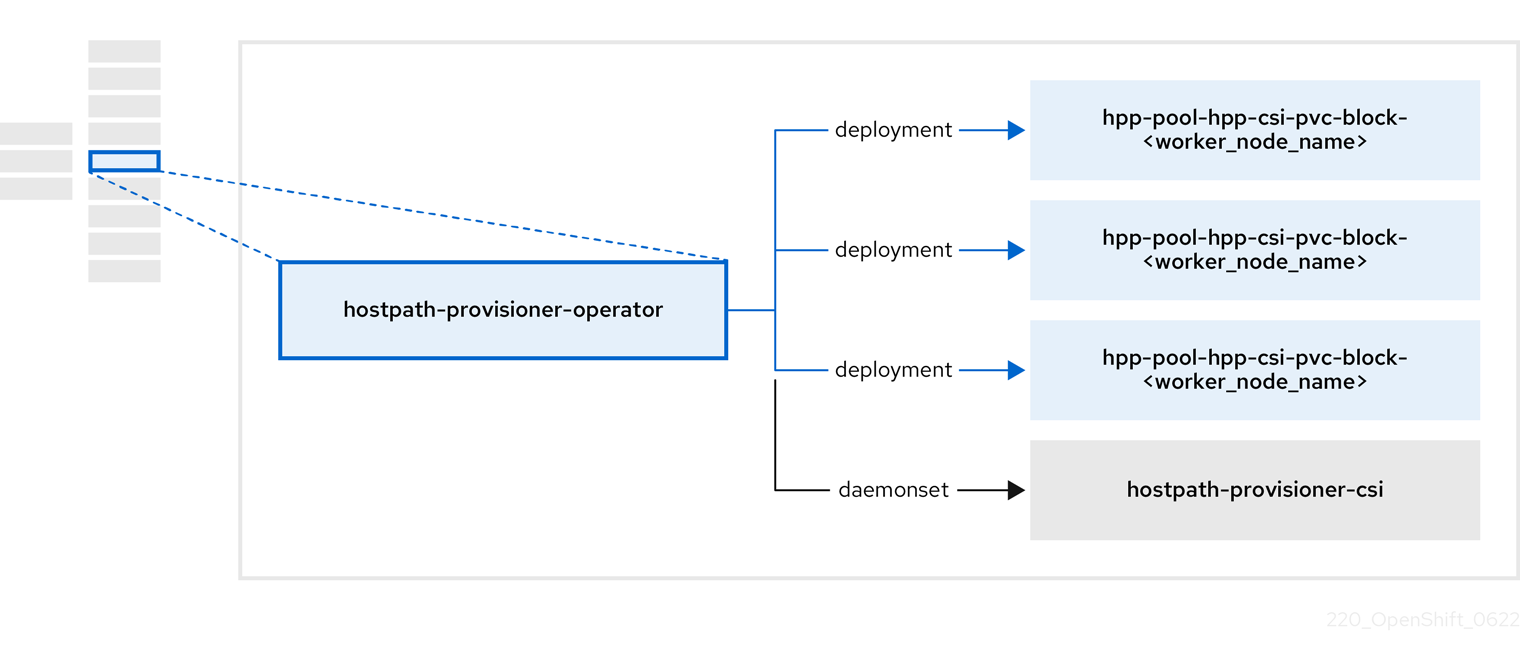

OLM 部署 Hostpath Provisioner (HPP) Operator,但在创建 hostpath-provisioner CR 前它无法正常工作。

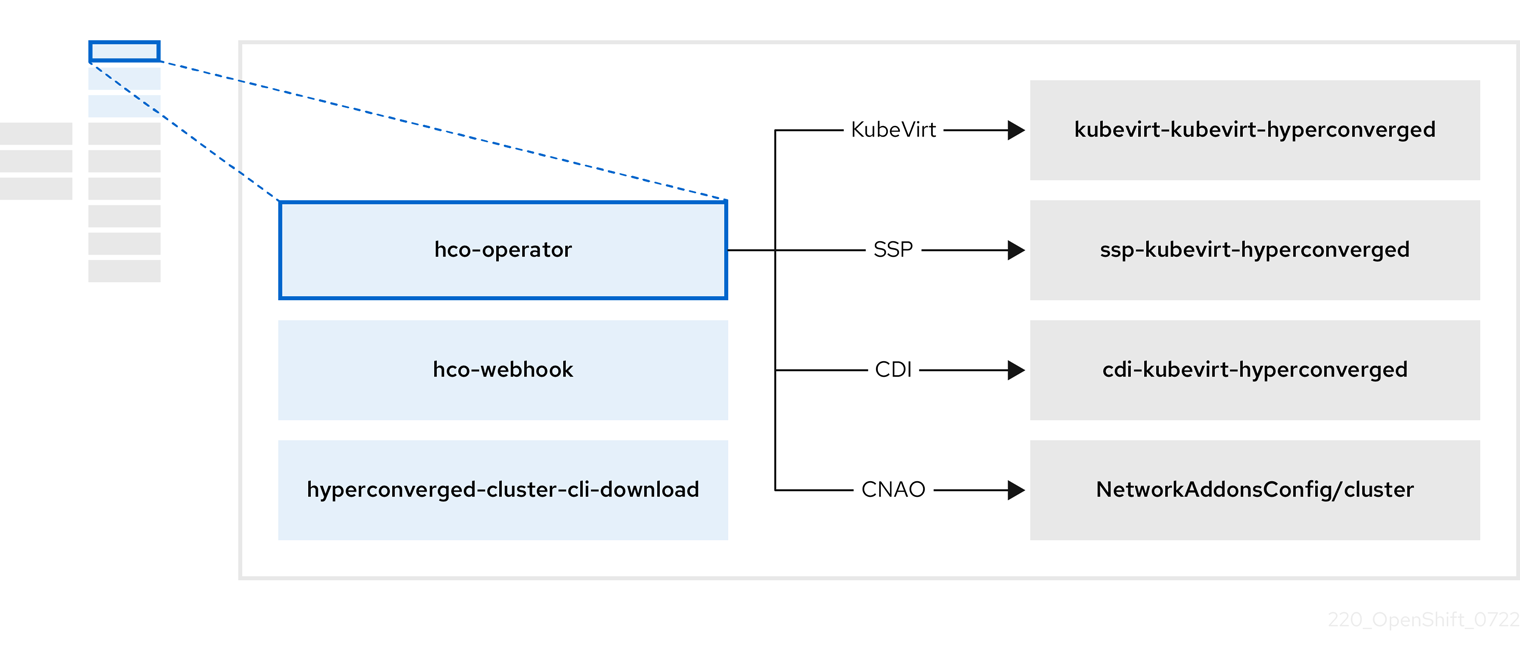

1.3.1. 关于 HyperConverged Operator (HCO)

HCO、hco-operator 提供了一种单一入口点,用于部署和管理 OpenShift Virtualization 和几个带有建议的默认值的帮助程序运算符。它还会为这些操作器创建自定义资源(CR)。

| 组件 | 描述 |

|---|---|

|

|

验证 |

|

|

提供 |

|

| 包含 OpenShift Virtualization 需要的所有 operator、CR 和对象。 |

|

| 调度、扩展和性能 (SSP) CR。这由 HCO 自动创建。 |

|

| Containerized Data Importer (CDI) CR。这由 HCO 自动创建。 |

|

|

指示并由 |

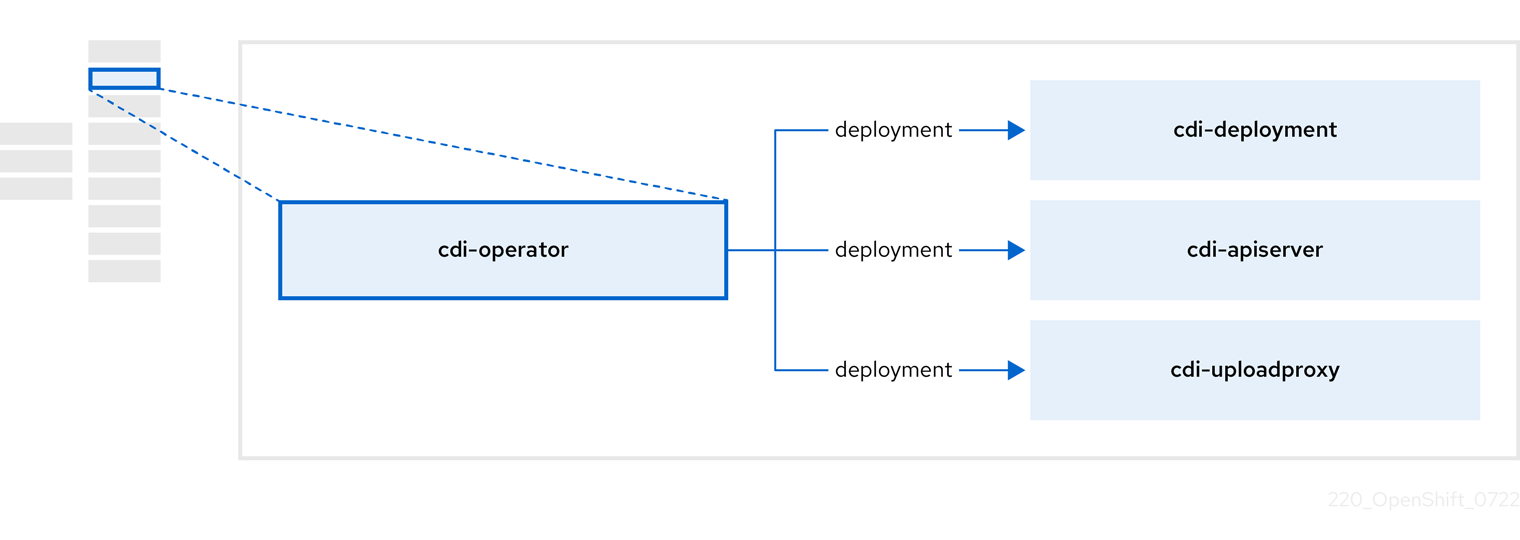

1.3.2. 关于 Containerized Data Importer (CDI) Operator

CDI Operator cdi-operator, 管理 CDI 及其相关资源,它使用数据卷将虚拟机(VM)镜像导入到持久性卷声明(PVC)中。

| 组件 | 描述 |

|---|---|

|

| 通过提供安全上传令牌来管理将虚拟机磁盘上传到 PVC 的授权过程。 |

|

| 将外部磁盘上传流量定向到适当的上传服务器 pod,以便将其写入正确的 PVC。需要有效的上传令牌。 |

|

| helper(帮助程序)Pod,在创建数据卷时将虚拟机镜像导入到 PVC 中。 |

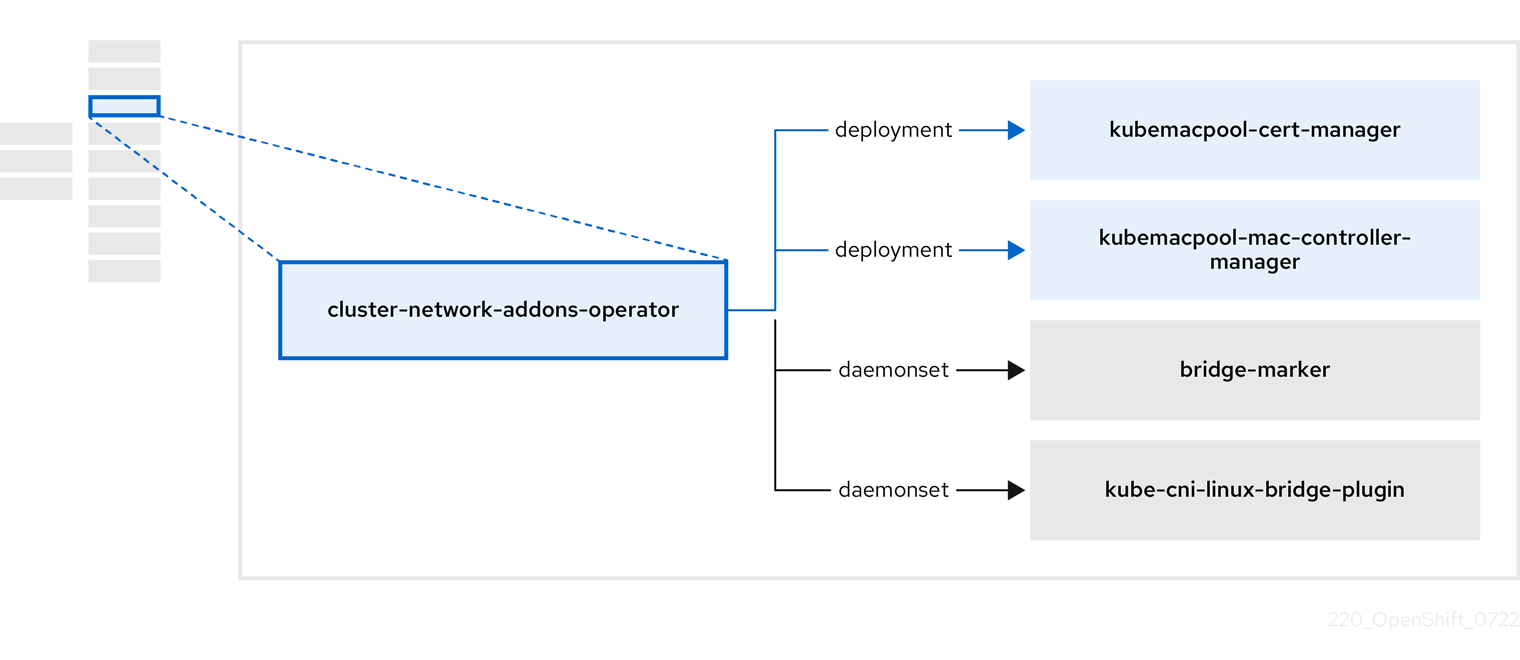

1.3.3. 关于 Cluster Network Addons Operator

Cluster Network Addons Operator cluster-network-addons-operator 在集群中部署网络组件,并管理扩展网络功能的相关资源。

| 组件 | 描述 |

|---|---|

|

| 管理 Kubemacpool 的 webhook 的 TLS 证书。 |

|

| 为虚拟机(VM)网络接口卡(NIC)提供 MAC 地址池服务。 |

|

| 将节点上可用的网络桥接标记为节点资源。 |

|

| 在集群节点上安装 Container Network Interface (CNI) 插件,通过网络附加定义将虚拟机附加到 Linux 网桥。 |

1.3.4. 关于 Hostpath Provisioner (HPP) Operator

HPP Operator hostpath-provisioner-operator,部署和管理多节点 HPP 和相关资源。

| 组件 | 描述 |

|---|---|

|

| 为指定 HPP 的每个节点提供一个 worker。pod 在节点上挂载指定的后备存储。 |

|

| 实现 HPP 的容器存储接口(CSI)驱动程序接口。 |

|

| 实现 HPP 的传统驱动程序接口。 |

1.3.5. 关于 Scheduling、Scale 和 Performance (SSP) Operator

SSP Operator、ssp-operator、部署通用模板、相关的默认引导源、管道任务和模板验证器。

1.3.6. 关于 OpenShift Virtualization Operator

OpenShift Virtualization Operator、virt-operator、部署、升级和管理 OpenShift Virtualization,而不影响当前虚拟机 (VM) 工作负载。另外,OpenShift Virtualization Operator 部署通用实例类型和通用首选项。

| 组件 | 描述 |

|---|---|

|

| 用作所有与虚拟化相关的流的入口点的 HTTP API 服务器。 |

|

|

观察创建新虚拟机实例对象并创建对应的 pod。当 pod 调度到某个节点上时, |

|

|

监控对虚拟机的任何更改并指示 |

|

|

包含由 |

第 2 章 发行注记

2.1. OpenShift Virtualization 发行注记

2.1.1. 提供文档反馈

要报告错误或改进文档,请登录到 Red Hat JIRA 帐户 并提交 JIRA 问题。

2.1.2. 关于 Red Hat OpenShift Virtualization

使用 Red Hat OpenShift Virtualization,您可以将传统虚拟机 (VM) 带入 OpenShift Container Platform 中,并将它们与容器一同运行。在 OpenShift Virtualization 中,虚拟机是可以使用 OpenShift Container Platform Web 控制台或命令行管理的原生 Kubernetes 对象。

OpenShift Virtualization 由

![]() 图标表示。

图标表示。

OpenShift Virtualization 可以与 OVN-Kubernetes 或 OpenShiftSDN 默认 Container Network Interface(CNI)网络供应商一起使用。

了解更多有关 OpenShift Virtualization 的作用。

了解更多有关 OpenShift Virtualization 架构和部署 的信息。

为 OpenShift Virtualization 准备集群。

2.1.2.1. OpenShift Virtualization 支持的集群版本

支持在 OpenShift Container Platform 4.16 集群中使用 OpenShift Virtualization 4.16。要使用 OpenShift Virtualization 的最新 z-stream 版本,您必须首先升级到 OpenShift Container Platform 的最新版本。

2.1.2.2. 支持的客户端操作系统

要查看 OpenShift Virtualization 支持的客户机操作系统,请参阅 Red Hat OpenStack Platform、Red Hat Virtualization、OpenShift Virtualization 和带有 KVM 的 Red Hat Enterprise Linux 中的认证的客户机操作系统。

2.1.2.3. Microsoft Windows SVVP 认证

OpenShift Virtualization 已在 Microsoft 的 Windows Server Virtualization Validation Program (SVVP) 中认证来运行 Windows Server 的工作负载。

SVVP 认证适用于:

- Red Hat Enterprise Linux CoreOS worker。在 Microsoft SVVP Catalog 中,它们名为 Red Hat OpenShift Container Platform 4 on RHEL CoreOS 9。

- Intel 和 AMD CPU。

2.1.3. 快速启动

有几个 OpenShift Virtualization 功能提供快速入门导览。要查看导览,请点 OpenShift Container Platform Web 控制台标题的菜单栏中的 Help 图标 ?,然后选择 Quick Starts。您可以通过在 Filter 字段中输入关键字 virtualization 来过滤可用的导览。

2.1.4. 新增和改变的功能

此发行版本添加了与以下组件和概念相关的新功能和增强:

2.1.4.1. 安装和更新

- 升级到 OpenShift Virtualization 4.16 后,之前通过垃圾回收移除的数据卷可能会重新创建。这是预期的行为。您可以忽略重新创建的数据卷,因为数据卷垃圾回收现在被禁用。

2.1.4.2. 虚拟化

- Windows 10 虚拟机现在使用带有 TPM 的 UEFI 引导。

-

启用

AutoResourceLimits功能门自动管理虚拟机的 CPU 和内存限值。 - KubeVirt Tekton 任务现在作为 OpenShift Container Platform Pipelines 目录 的一部分提供。

2.1.4.3. 网络

- 现在,您可以使用无头服务,访问连接到一个具有稳定 FQDN 的默认内部 pod 网络的虚拟机。

2.1.4.4. Web 控制台

-

现在,将虚拟 CPU (vCPU)热插到虚拟机已正式发布。如果无法热插 vCPU,则条件

RestartRequired会应用到虚拟机。您可以在 web 控制台的 Diagnoses 选项卡中查看此条件。

-

现在,您可以在从实例类型创建 Microsoft Windows 虚拟机时选择

sysprep选项。在以前的版本中,您必须在创建后通过自定义虚拟机来设置sysprep选项。

2.1.4.5. 监控

作为管理员,您可以通过启用

downwardMetrics功能门并配置一个downwardMetrics设备,为 OpenShift Virtualization 通过 virtio-serial 端口向客户虚拟机公开有限的主机和虚拟机 (VM) 指标。用户使用vm-dump-metrics工具或从命令行检索指标。在 Red Hat Enterprise Linux (RHEL) 9 中,使用命令行查看 downward 指标。Red Hat Enterprise Linux (RHEL) 9 平台不支持

vm-dump-metrics工具。

2.1.4.6. 主要的技术变化

- 虚拟机至少需要 1 GiB 分配内存才能启用内存热插。如果虚拟机分配的内存小于 1 GiB,则禁用内存热插。

-

OpenShift Virtualization 警报的 runbooks 现在只在

openshift/runbooksgit 存储库中维护。现在,到 runbook 源文件的链接可以来代替删除的 runbook。

2.1.5. 弃用和删除的功能

2.1.5.1. 已弃用的功能

弃用的功能包括在当前发行版本中,并被支持。但是,弃用的功能将在以后的发行版本中被删除,且不建议在新部署中使用。

-

tekton-tasks-operator已被弃用,Tekton 任务和示例管道现在由ssp-operator部署。

-

copy-template,modify-vm-template, 和create-vm-from-template任务已弃用。

- 对 Windows Server 2012 R2 模板的支持已弃用。

-

警报

KubeVirtComponentExceedsRequestedMemory和KubeVirtComponentExceedsRequestedCPU已被弃用。您可以安全地静默它们。

2.1.5.2. 删除的功能

当前版本不支持删除的功能。

- CentOS 7 和 CentOS Stream 8 现在处于生命周期结束。因此,这些操作系统的容器镜像已从 OpenShift Virtualization 中删除,不再受 社区支持。

2.1.6. 技术预览功能

这个版本中的一些功能当前还处于技术预览状态。它们并不适用于在生产环境中使用。请参阅红帽门户网站中关于对技术预览功能支持范围的信息:

- 现在,您可以在 OpenShift Virtualization 主机中启用嵌套虚拟化。

- 集群管理员现在可以在 OpenShift Container Platform Web 控制台的 Overview → Settings → Preview features 下对命名空间启用 CPU 资源限值。

-

集群管理员现在可以使用

wasp-agent工具通过过量使用内存量、在 RAM 中并将交换资源分配给虚拟机工作负载,在其 集群中配置更高的虚拟机工作负载密度。

- OpenShift Virtualization 现在支持与 Red Hat OpenShift Data Foundation (ODF) 区域灾难恢复的兼容性。

2.1.7. 已知问题

监控

节点

-

卸载 OpenShift Virtualization 不会删除 OpenShift Virtualization 创建的

feature.node.kubevirt.io节点标签。您必须手动删除标签。(CNV-38543)

- 在具有不同计算节点的异构集群中,启用了 HyperV Reenlightenment 的虚拟机无法调度到不支持时间戳扩展 (TSC) 或具有适当 TSC 频率的节点。(BZ#2151169)

Storage

如果您在 AWS 上使用 Portworx 作为存储解决方案并创建虚拟机磁盘镜像,则创建的镜像可能会小于预期,因为文件系统开销被认为是两次。(CNV-40217)

- 作为临时解决方案,您可以手动扩展持久性卷声明 (PVC),以便在初始置备过程完成后增加可用空间。

在某些情况下,多个虚拟机可以以读写模式挂载相同的 PVC,这可能会导致数据崩溃。(CNV-13500)

- 作为临时解决方案,请避免在使用多个虚拟机的读写模式中使用单个 PVC。

如果您使用

csi-clone克隆策略克隆超过 100 个虚拟机,则 Ceph CSI 可能无法清除克隆。手动删除克隆也可能会失败。(CNV-23501)-

作为临时解决方案,您可以重启

ceph-mgr来清除虚拟机克隆。

-

作为临时解决方案,您可以重启

虚拟化

在具有混合 CPU 类型的集群中虚拟机迁移可能会失败。(CNV-43195)

- 作为临时解决方案,您可以在 VM spec 级别或集群级别设置 CPU 模型。

-

当在 Windows 虚拟机中添加虚拟受信任的平台模块 (vTPM) 设备时,BitLocker Drive Encryption 系统检查通过,即使 vTPM 设备没有持久性。这是因为 vTPM 设备不是持久性存储,并在

virt-launcherpod 生命周期中使用临时存储恢复加密密钥。当虚拟机迁移或关闭并重启时,vTPM 数据会丢失。(CNV-36448)

OpenShift Virtualization 将 pod 使用的服务帐户令牌链接到该特定 pod。OpenShift Virtualization 通过创建包含令牌的磁盘镜像来实施服务帐户卷。如果您迁移虚拟机,则服务帐户卷无效。(CNV-33835)

- 作为临时解决方案,使用用户帐户而不是服务帐户,因为用户帐户令牌没有绑定到特定 pod。

随着 RHSA-2023:3722 公告的发布,在启用了 FIPS 的 Red Hat Enterprise Linux (RHEL) 9 系统上,对 TLS 1.2 连接强制

Extended Master Secret(EMS)扩展 (RFC 7627) 。这符合 FIPS-140-3 要求。TLS 1.3 不受影响。不支持 EMS 或 TLS 1.3 的旧的 OpenSSL 客户端现在无法连接到运行在 RHEL 9 上的 FIPS 服务器。同样,FIPS 模式下的 RHEL 9 客户端无法连接到只支持没有 EMS 的 TLS 1.2 服务器。在实践中意味着这些客户端无法连接到 RHEL 6、RHEL 7 和非 RHEL 传统操作系统上的服务器。这是因为传统的 OpenSSL 1.0.x 版本不支持 EMS 或 TLS 1.3。如需更多信息,请参阅 使用 Red Hat Enterprise Linux 9.2 强制执行的 TLS 扩展 "Extended Master Secret" 。

-

作为临时解决方案,将旧的 OpenSSL 客户端升级到支持 TLS 1.3 的版本,并将 OpenShift Virtualization 配置为使用 TLS 1.3,为 FIPS 模式使用

ModernTLS 安全配置集类型。

-

作为临时解决方案,将旧的 OpenSSL 客户端升级到支持 TLS 1.3 的版本,并将 OpenShift Virtualization 配置为使用 TLS 1.3,为 FIPS 模式使用

Web 控制台

首次部署 OpenShift Container Platform 集群时,使用 Web 控制台从模板或实例类型创建虚拟机,如果您没有

cluster-admin权限,则会失败。

- 当您通过从 web 控制台中的 Create PersistentVolumeClaim 列表中选择 With Data upload form 来创建持久性卷声明 (PVC) 时,使用 Upload Data 字段将数据上传到 PVC 会失败。(CNV-37607)

第 3 章 开始使用

3.1. OpenShift Virtualization 入门

您可以通过安装和配置基本环境来探索 OpenShift Virtualization 的功能和功能。

集群配置过程需要 cluster-admin 权限。

3.1.1. 规划和安装 OpenShift Virtualization

在 OpenShift Container Platform 集群中计划并安装 OpenShift Virtualization:

规划和安装资源

3.1.2. 创建和管理虚拟机

创建虚拟机:

您可以使用红帽模板或实例类型创建虚拟机。

您可以通过从容器 registry 或网页导入自定义镜像来创建虚拟机,方法是从本地机器上传镜像,或者克隆持久性卷声明(PVC)。

将虚拟机连接到二级网络:

- Linux 网桥网络.

- 打开虚拟网络(OVN)-Kubernetes 辅助网络。

- 注意

默认情况下,虚拟机连接到 pod 网络。

连接到虚拟机:

管理虚拟机:

3.1.3. 后续步骤

3.2. 使用 CLI 工具

您可使用 virtctl 命令行工具管理 OpenShift Virtualization 资源。

您可以使用 libguestfs 命令行工具访问和修改虚拟机(VM)磁盘镜像。您可以使用 virtctl libguestfs 命令部署 libguestfs。

3.2.1. 安装 virtctl

要在 Red Hat Enterprise Linux (RHEL) 9、Linux、Windows 和 MacOS 操作系统上安装 virtctl,您可以下载并安装 virtctl 二进制文件。

要在 RHEL 8 上安装 virtctl,您可以启用 OpenShift Virtualization 仓库,然后安装 kubevirt-virtctl 软件包。

3.2.1.1. 在 RHEL 9、Linux、Windows 或 macOS 上安装 virtctl 二进制文件

您可以从 OpenShift Container Platform web 控制台下载适用于操作系统的 virtctl 二进制文件,然后安装它。

流程

- 在 web 控制台中进入到 Virtualization → Overview 页面。

-

点 Download virtctl 链接为您的操作系统下载

virtctl二进制文件。 安装

virtctl:对于 RHEL 9 和其他 Linux 操作系统:

解压缩存档文件:

$ tar -xvf <virtctl-version-distribution.arch>.tar.gz

运行以下命令使

virtctl二进制可执行文件:$ chmod +x <path/virtctl-file-name>

将

virtctl二进制文件移到PATH环境变量中的目录中。您可以运行以下命令来检查您的路径:

$ echo $PATH

设置

KUBECONFIG环境变量:$ export KUBECONFIG=/home/<user>/clusters/current/auth/kubeconfig

对于 Windows:

- 解压缩存档文件。

-

进入解压的目录中,双击

virtctl可执行文件来安装客户端。 将

virtctl二进制文件移到PATH环境变量中的目录中。您可以运行以下命令来检查您的路径:

C:\> path

macOS:

- 解压缩存档文件。

将

virtctl二进制文件移到PATH环境变量中的目录中。您可以运行以下命令来检查您的路径:

echo $PATH

3.2.1.2. 在 RHEL 8 上安装 virtctl RPM

您可以通过启用 OpenShift Virtualization 仓库并安装 kubevirt-virtctl 软件包,在 Red Hat Enterprise Linux (RHEL) 8 上安装 virtctl RPM 软件包。

先决条件

- 集群中的每个主机都必须通过 Red Hat Subscription Manager (RHSM) 注册,并具有有效的 OpenShift Container Platform 订阅。

流程

使用

subscription-managerCLI 工具启用 OpenShift Virtualization 存储库,以运行以下命令:# subscription-manager repos --enable cnv-4.16-for-rhel-8-x86_64-rpms

运行以下命令安装

kubevirt-virtctl软件包:# yum install kubevirt-virtctl

3.2.2. virtctl 命令

virtctl 客户端是用于管理 OpenShift Virtualization 资源的命令行实用程序。

除非另有指定,否则虚拟机(VM)命令也适用于虚拟机实例(VMI)。

3.2.2.1. virtctl 信息命令

您可使用 virtctl 信息命令查看 virtctl 客户端的信息。

| 命令 | 描述 |

|---|---|

|

|

查看 |

|

|

查看 |

|

| 查看特定命令的选项列表。 |

|

|

查看任何 |

3.2.2.2. VM 信息命令

您可使用 virtctl 查看有关虚拟机(VM)和虚拟机实例(VMI)的信息。

| 命令 | 描述 |

|---|---|

|

| 查看客户机机器上可用的文件系统。 |

|

| 查看客户机机器上操作系统的信息。 |

|

| 查看客户机机器上的登录用户。 |

3.2.2.3. VM 清单创建命令

您可使用 virtctl create 命令为虚拟机、实例类型和首选项创建清单。

| 命令 | 描述 |

|---|---|

|

创建 |

|

| 创建虚拟机清单,指定虚拟机的名称。 |

|

| 创建使用现有集群范围实例类型的虚拟机清单。 |

|

| 创建使用现有命名空间的实例类型的虚拟机清单。 |

|

| 为集群范围的实例类型创建清单。 |

|

| 为命名空间实例类型创建清单。 |

|

| 为集群范围的虚拟机首选项创建清单,为首选项指定一个名称。 |

|

| 为命名空间虚拟机首选项创建清单。 |

3.2.2.4. VM 管理命令

您可使用 virtctl 虚拟机(VM)管理命令管理和迁移虚拟机(VM)和虚拟机实例(VMI)。

| 命令 | 描述 |

|---|---|

|

| 启动虚拟机。 |

|

| 以暂停状态启动虚拟机。这个选项可让您从 VNC 控制台中断引导过程。 |

|

| 停止虚拟机。 |

|

| 强制停止虚拟机。这个选项可能会导致数据不一致或数据丢失。 |

|

| 暂停虚拟机。机器状态保存在内存中。 |

|

| 取消暂停虚拟机。 |

|

| 迁移虚拟机。 |

|

| 取消虚拟机迁移。 |

|

| 重启虚拟机。 |

3.2.2.5. VM 连接命令

您可使用 virtctl connection 命令来公开端口并连接到虚拟机(VM)和虚拟机实例(VMI)。

| 命令 | 描述 |

|---|---|

|

| 连接到虚拟机的串行控制台。 |

|

| 创建转发虚拟机的指定端口的服务,并在节点的指定端口上公开服务。

示例: |

|

| 将文件从机器复制到虚拟机。此命令使用 SSH 密钥对的私钥。虚拟机必须配置有公钥。 |

|

| 将文件从虚拟机复制到您的机器中。此命令使用 SSH 密钥对的私钥。虚拟机必须配置有公钥。 |

|

| 与虚拟机打开 SSH 连接。此命令使用 SSH 密钥对的私钥。虚拟机必须配置有公钥。 |

|

| 连接到虚拟机的 VNC 控制台。

已安装 |

|

| 显示端口号,并使用任何查看器通过 VNC 连接手动连接到 VMI。 |

|

| 如果该端口可用,则指定端口号用于在指定端口上运行代理。 如果没有指定端口号,代理会在随机端口上运行。 |

3.2.2.6. VM 导出命令

使用 virtctl vmexport 命令来创建、下载或删除从虚拟机、虚拟机快照或持久性卷声明 (PVC) 导出的卷。某些清单还包含标头 secret,它授予对端点的访问权限,以 OpenShift Virtualization 可以使用的格式导入磁盘镜像。

| 命令 | 描述 |

|---|---|

|

|

创建一个

|

|

|

手动删除 |

|

|

下载在

可选:

|

|

|

创建一个 |

|

| 检索一个现有导出的清单。清单不包括标头 secret。 |

|

| 为虚拟机创建虚拟机导出,并检索清单。清单不包括标头 secret。 |

|

| 为虚拟机快照示例创建虚拟机导出,并检索清单。清单不包括标头 secret。 |

|

| 检索一个现有导出的清单。清单包括标头 secret。 |

|

| 以 json 格式检索现有导出的清单。清单不包括标头 secret。 |

|

| 检索一个现有导出的清单。清单包括标头 secret,并将其写入指定的文件中。 |

3.2.2.7. VM 内存转储命令

您可使用 virtctl memory-dump 命令在 PVC 上输出虚拟机 (VM) 内存转储。您可以指定现有的 PVC,或使用 --create-claim 标志来创建新 PVC。

先决条件

-

PVC 卷模式必须是

FileSystem。 PVC 必须足够大以保存内存转储。

计算 PVC 大小的公式为

(VMMemorySize + 100Mi)* FileSystemOverhead,其中100Mi是内存转储开销。您必须运行以下命令来在

HyperConverged自定义资源中启用热插功能:$ oc patch hyperconverged kubevirt-hyperconverged -n openshift-cnv \ --type json -p '[{"op": "add", "path": "/spec/featureGates", \ "value": "HotplugVolumes"}]'

下载内存转储

您必须使用 virtctl vmexport download 命令下载内存转储:

$ virtctl vmexport download <vmexport_name> --vm|pvc=<object_name> \ --volume=<volume_name> --output=<output_file>

| 命令 | 描述 |

|---|---|

|

|

在 PVC 上保存虚拟机的内存转储。内存转储状态显示在 可选:

|

|

|

使用相同的 PVC 重新运行 这个命令覆盖以前的内存转储。 |

|

| 删除内存转储。 如果要更改目标 PVC,则必须手动删除内存转储。

这个命令会删除虚拟机和 PVC 之间的关联,以便在 |

3.2.2.8. 热插和热拔命令

您可使用 virtctl 从正在运行的虚拟机(VM)和虚拟机实例(VMI)中添加或删除资源。

| 命令 | 描述 |

|---|---|

|

| 热插数据卷或持久性卷声明 (PVC)。 可选:

|

|

| 热拔虚拟磁盘。 |

|

| 热插 Linux 网桥网络接口。 |

|

| 热拔 Linux 网桥网络接口。 |

3.2.2.9. 镜像上传命令

您可使用 virtctl image-upload 命令将虚拟机镜像上传到数据卷中。

| 命令 | 描述 |

|---|---|

|

| 将虚拟机镜像上传到已存在的数据卷中。 |

|

| 将虚拟机镜像上传到指定请求大小的新数据卷中。 |

3.2.3. 使用 virtctl 部署 libguestfs

您可以使用 virtctl guestfs 命令部署带有 libguestfs-tools 以及附加到它的持久性卷声明 (PVC) 的交互式容器。

流程

要部署一个带有

libguestfs-tools的容器,挂载 PVC 并为其附加一个 shell,运行以下命令:$ virtctl guestfs -n <namespace> <pvc_name> 1- 1

- PVC 名称是必需的参数。如果没有包括它,则会出现错误消息。

3.2.3.1. libguestfs 和 virtctl guestfs 命令

libguestfs 工具可帮助您访问和修改虚拟机 (VM) 磁盘镜像。您可以使用 libguestfs 工具查看和编辑客户机中的文件、克隆和构建虚拟机,以及格式化和调整磁盘大小。

您还可以使用 virtctl guestfs 命令及其子命令在 PVC 上修改、检查和调试虚拟机磁盘。要查看可能子命令的完整列表,请在命令行中输入 virt- 并按 Tab 键。例如:

| 命令 | 描述 |

|---|---|

|

| 在终端中以交互方式编辑文件。 |

|

| 将 ssh 密钥注入客户系统并创建登录。 |

|

| 查看虚拟机使用了多少磁盘空间。 |

|

| 通过创建包含完整列表的输出文件,查看虚拟客户机上安装的所有 RPM 的完整列表。 |

|

|

在终端中使用 |

|

| 封装要用作模板的虚拟机磁盘镜像。 |

默认情况下,virtctl guestfs 会创建一个会话,其中包含管理 VM 磁盘所需的一切内容。但是,如果想要自定义行为,该命令还支持几个标志选项:

| 标记选项 | 描述 |

|---|---|

|

|

为 |

|

带有 | 使用特定命名空间中的 PVC。

如果不使用

如果没有包括 |

|

|

列出

您可以使用 |

|

|

代表

默认情况下,

如果群集没有任何

如果没有设置, |

|

|

显示

您还可以通过设置 |

这个命令还会检查 PVC 是否被另一个 pod 使用,这时会出现错误消息。但是,libguestfs-tools 进程启动后,设置无法避免使用相同的 PVC 的新 pod。在启动虚拟机访问同一 PVC 前,您必须先验证没有活跃的 virtctl guestfs pod。

virtctl guestfs 命令只接受附加到交互式 pod 的单个 PVC。

3.2.4. 使用 Ansible

要使用 OpenShift Virtualization 的 Ansible 集合,请参阅 Red Hat Ansible Automation Hub (Red Hat Hybrid Cloud Console)。

第 4 章 安装

4.1. 为 OpenShift Virtualization 准备集群

在安装 OpenShift Virtualization 前,参阅这个部分以确保集群满足要求。

- 安装方法注意事项

- 您可以使用任何安装方法(包括用户置备的、安装程序置备或辅助安装程序)来部署 OpenShift Container Platform。但是,安装方法和集群拓扑可能会影响 OpenShift Virtualization 功能,如快照或实时迁移。

- Red Hat OpenShift Data Foundation

- 如果使用 Red Hat OpenShift Data Foundation 部署 OpenShift Virtualization,您必须为 Windows 虚拟机磁盘创建一个专用存储类。详情请参阅为 Windows 虚拟机优化 ODF PersistentVolume。

- IPv6

- 您无法在单堆栈 IPv6 集群上运行 OpenShift Virtualization。

FIPS 模式

如果使用 FIPS 模式安装集群,则 OpenShift Virtualization 不需要额外的设置。

4.1.1. 支持的平台

您可以在 OpenShift Virtualization 中使用以下平台:

- 内部裸机服务器。请参阅为 OpenShift Virtualization 规划裸机集群。

- Amazon Web Services 裸机实例。请参阅使用自定义在 AWS 上安装集群

IBM Cloud® 裸机服务器。请参阅在 IBM Cloud® Bare Metal 节点上部署 OpenShift Virtualization。

重要在 IBM Cloud® 裸机服务器上安装 OpenShift Virtualization 只是一个技术预览功能。技术预览功能不受红帽产品服务等级协议(SLA)支持,且功能可能并不完整。红帽不推荐在生产环境中使用它们。这些技术预览功能可以使用户提早试用新的功能,并有机会在开发阶段提供反馈意见。

有关红帽技术预览功能支持范围的更多信息,请参阅技术预览功能支持范围。

不支持由其他云供应商提供的裸机实例或服务器。

4.1.1.1. AWS 裸机上的 OpenShift Virtualization

您可以在 Amazon Web Services (AWS) 裸机 OpenShift Container Platform 集群上运行 OpenShift Virtualization。

OpenShift Virtualization 也支持 Red Hat OpenShift Service on AWS (ROSA) Classic 集群,其配置要求与 AWS 裸机集群相同。

在设置集群前,请查看以下支持的功能和限制概述:

- 安装

您可以使用安装程序置备的基础架构安装集群,确保为 worker 节点指定裸机实例类型。例如,您可以对基于 x86_64 架构的机器使用

c5n.metal类型值。您可以通过编辑install-config.yaml文件来指定裸机实例类型。如需更多信息,请参阅在 AWS 上安装 OpenShift Container Platform 文档。

- 访问虚拟机 (VM)

-

使用

virtctlCLI 工具或 OpenShift Container Platform Web 控制台没有更改您如何访问虚拟机。 您可以使用

NodePort或LoadBalancer服务公开虚拟机。- 负载均衡器方法是首选的,因为 OpenShift Container Platform 会在 AWS 中自动创建负载均衡器并管理其生命周期。另外,还会为负载均衡器创建一个安全组,您可以使用注解来附加现有的安全组。删除服务时,OpenShift Container Platform 会移除负载均衡器及其关联的资源。

- 网络

- 您不能使用单根 I/O 虚拟化 (SR-IOV) 或桥接 Container Network Interface (CNI) 网络,包括虚拟 LAN (VLAN)。如果您的应用程序需要扁平第 2 层网络或对 IP 池进行控制,请考虑使用 OVN-Kubernetes 二级覆盖网络。

- Storage

您可以使用存储厂商认证的任何存储解决方案与底层平台一起使用。

重要AWS 裸机和 ROSA 集群可能有不同的存储解决方案。确保您确认支持您的存储供应商。

在 OpenShift Virtualization 中使用 Amazon Elastic File System (EFS) 或 Amazon Elastic Block Store (EBS) 可能会导致性能和功能限制,如下表所示:

表 4.1. EFS 和 EBS 性能和功能限制 功能 EBS 卷 EFS 卷 共享存储解决方案 gp2

gp3

io2

VM 实时迁移

不可用

不可用

Available

Available

Available

使用克隆快速创建虚拟机

Available

不可用

Available

使用快照进行虚拟机备份和恢复

Available

不可用

Available

考虑使用支持 ReadWriteMany (RWX)、克隆和快照的 CSI 存储来启用实时迁移、快速虚拟机创建和虚拟机快照功能。

- 托管 control plane (HCP)

- 目前 AWS 基础架构不支持 OpenShift Virtualization 的 HCP。

4.1.2. 硬件和操作系统要求

查看 OpenShift Virtualization 的以下硬件和操作系统要求。

4.1.2.1. CPU 要求

由 Red Hat Enterprise Linux (RHEL) 9 支持。

参阅用于支持的 CPU 红帽生态系统目录。

注意如果您的 worker 节点有不同的 CPU,则可能会出现实时迁移失败,因为不同的 CPU 具有不同的功能。您可以通过确保 worker 节点具有适当容量的 CPU,并为虚拟机配置节点关联性规则来缓解这个问题。

详情请参阅配置所需的节点关联性规则。

- 支持 AMD 和 Intel 64 位架构 (x86-64-v2)。

- 支持 Intel 64 或 AMD64 CPU 扩展。

- 启用 Intel VT 或 AMD-V 硬件虚拟化扩展。

- 启用 NX (无执行)标记。

4.1.2.2. 操作系统要求

在 worker 节点上安装的 Red Hat Enterprise Linux CoreOS (RHCOS)。

详情请参阅 RHCOS。

注意不支持 RHEL worker 节点。

4.1.2.3. 存储要求

- OpenShift Container Platform 支持。请参阅优化存储。

- 您必须创建一个默认的 OpenShift Virtualization 或 OpenShift Container Platform 存储类。这样做的目的是解决虚拟机工作负载的唯一存储需求,并提供优化的性能、可靠性和用户体验。如果 OpenShift Virtualization 和 OpenShift Container Platform 默认存储类都存在,则 OpenShift Virtualization 类在创建虚拟机磁盘时具有优先权。

要将存储类标记为虚拟化工作负载的默认值,请将注解 storageclass.kubevirt.io/is-default-virt-class 设置为 "true"。

-

如果存储置备程序支持快照,您必须将

VolumeSnapshotClass对象与默认存储类关联。

4.1.2.3.1. 关于虚拟机磁盘的卷和访问模式

如果您将存储 API 与已知的存储供应商搭配使用,则会自动选择卷和访问模式。但是,如果您使用没有存储配置集的存储类,您必须配置卷和访问模式。

要获得最佳结果,请使用 ReadWriteMany (RWX)访问模式和 Block 卷模式。这一点非常重要:

-

实时迁移需要

ReadWriteMany(RWX) 访问模式。 块卷模式的性能优于Filesystem卷模式。这是因为Filesystem卷模式使用更多存储层,包括文件系统层和磁盘镜像文件。虚拟机磁盘存储不需要这些层。例如,如果您使用 Red Hat OpenShift Data Foundation,Ceph RBD 卷优先于 CephFS 卷。

您不能使用以下配置实时迁移虚拟机:

-

具有

ReadWriteOnce(RWO) 访问模式的存储卷 - 透传功能,比如 GPU

对于这些虚拟机,将 evictionStrategy 字段设置为 None。None 策略会在节点重启过程中关闭虚拟机。

4.1.3. 实时迁移要求

-

使用

ReadWriteMany(RWX)访问模式的共享存储. 足够的 RAM 和网络带宽。

注意您必须确保集群中有足够的内存请求容量来支持节点排空会导致实时迁移。您可以使用以下计算来确定大约所需的备用内存:

Product of (Maximum number of nodes that can drain in parallel) and (Highest total VM memory request allocations across nodes)

集群中可以并行运行的迁移数量的默认值为 5。

- 如果虚拟机使用主机型号 CPU,则节点必须支持虚拟机的主机型号 CPU。

- 强烈建议使用专用的 Multus 网络进行实时迁移。专用网络可最小化迁移期间对租户工作负载网络饱和的影响。

4.1.4. 物理资源开销要求

OpenShift Virtualization 是 OpenShift Container Platform 的一个附加组件,它会带来额外的开销。除了 OpenShift Container Platform 要求外,每个集群机器都必须满足以下开销要求。覆盖集群中的物理资源可能会影响性能。

本文档中给出的数字基于红帽的测试方法和设置。这些数字会根据您自己的设置和环境而有所不同。

内存开销

使用以下因素计算 OpenShift Virtualization 的内存开销值。

集群内存开销

Memory overhead per infrastructure node ≈ 150 MiB

Memory overhead per worker node ≈ 360 MiB

另外,OpenShift Virtualization 环境资源需要总计 2179 MiB 的内存,分布到所有基础架构节点。

虚拟机内存开销

Memory overhead per virtual machine ≈ (1.002 × requested memory) \

+ 218 MiB \ 1

+ 8 MiB × (number of vCPUs) \ 2

+ 16 MiB × (number of graphics devices) \ 3

+ (additional memory overhead) 4

CPU 开销

使用以下内容计算 OpenShift Virtualization 的集群处理器开销要求。每个虚拟机的 CPU 开销取决于您的单独设置。

集群 CPU 开销

CPU overhead for infrastructure nodes ≈ 4 cores

OpenShift Virtualization 增加集群级别服务的整体使用,如日志记录、路由和监控。要考虑这个工作负载,请确保托管基础架构组件的节点分配了用于不同节点的 4 个额外内核(4000 毫秒)的容量。

CPU overhead for worker nodes ≈ 2 cores + CPU overhead per virtual machine

除了虚拟机工作负载所需的 CPU 外,每个托管虚拟机的 worker 节点都必须有 2 个额外内核(2000 毫秒)用于 OpenShift Virtualization 管理工作负载。

虚拟机 CPU 开销

如果请求专用 CPU,则会对集群 CPU 开销要求有 1:1 影响。否则,没有有关虚拟机所需 CPU 数量的具体规则。

存储开销

使用以下指南来估算 OpenShift Virtualization 环境的存储开销要求。

集群存储开销

Aggregated storage overhead per node ≈ 10 GiB

10 GiB 在安装 OpenShift Virtualization 时,集群中每个节点的磁盘存储影响估计值。

虚拟机存储开销

每个虚拟机的存储开销取决于虚拟机内的具体资源分配请求。该请求可能用于集群中其他位置托管的节点或存储资源的临时存储。OpenShift Virtualization 目前不会为正在运行的容器本身分配任何额外的临时存储。

Example

作为集群管理员,如果您计划托管集群中的 10 个虚拟机,每个虚拟机都有 1 GiB RAM 和 2 个 vCPU,集群中的内存影响为 11.68 GiB。集群中每个节点的磁盘存储影响估算为 10 GiB,托管虚拟机工作负载的 worker 节点的 CPU 影响最小 2 个内核。

4.1.5. 单节点 Openshift 的不同

您可以在单节点 OpenShift 上安装 OpenShift Virtualization。

但是,您应该注意单节点 OpenShift 不支持以下功能:

- 高可用性

- Pod 中断预算

- 实时迁移

- 配置了驱除策略的虚拟机或模板

4.1.6. 对象最大值

在规划集群时,您必须考虑以下测试的对象最大值:

4.1.7. 集群高可用性选项

您可以为集群配置以下高可用性(HA)选项之一:

通过部署机器健康检查,可以使用安装程序置备的基础架构 (IPI)自动高可用性。

注意在使用安装程序置备的基础架构安装的 OpenShift Container Platform 集群中,并使用正确配置的

MachineHealthCheck资源,如果节点无法进行机器健康检查,且对集群不可用,则会回收它。在故障节点上运行的虚拟机之后会发生什么,这取决于一系列条件。如需有关潜在结果以及运行策略如何影响这些结果的详细信息,请参阅运行策略。-

通过在 OpenShift Container Platform 集群上使用 Node Health Check Operator 来部署

NodeHealthCheck控制器,可以使用 IPI 和非 IPI 自动高可用性。控制器识别不健康的节点并使用补救供应商,如 Self Node Remediation Operator 或 Fence Agents Remediation Operator 来修复不健康的节点。如需有关补救、隔离和维护节点的更多信息,请参阅 Red Hat OpenShift 文档中的工作负载可用性。 任何平台的高可用性可通过使用监控系统或合格的人类监控节点可用性来实现。当节点丢失时,关闭并运行

oc delete node <lost_node>。注意如果没有外部监控系统或合格的人类监控节点运行状况,虚拟机就失去高可用性。

4.2. 安装 OpenShift Virtualization

安装 OpenShift Virtualization 以便在 OpenShift Container Platform 集群中添加虚拟化功能。

如果在没有互联网连接的受限环境中安装 OpenShift Virtualization,您必须为受限网络配置 Operator Lifecycle Manager (OLM)。

如果您有有限的互联网连接,您可以在 OLM 中配置代理支持,以访问 OperatorHub。

4.2.1. 安装 OpenShift Virtualization Operator

使用 OpenShift Container Platform Web 控制台或命令行安装 OpenShift Virtualization Operator。

4.2.1.1. 使用 Web 控制台安装 OpenShift Virtualization Operator

您可以使用 OpenShift Container Platform Web 控制台部署 OpenShift Virtualization Operator。

先决条件

- 在集群上安装 OpenShift Container Platform 4.16。

-

以具有

cluster-admin权限的用户身份登录到 OpenShift Container Platform web 控制台。

流程

- 从 Administrator 视角中,点 Operators → OperatorHub。

- 在 Filter by keyword 字段中,键入 Virtualization。

- 选择带有 Red Hat source 标签的 OpenShift Virtualization Operator 标题。

- 阅读 Operator 信息并单击 Install。

在 Install Operator 页面中:

- 从可用 Update Channel 选项列表中选择 stable。这样可确保安装与 OpenShift Container Platform 版本兼容的 OpenShift Virtualization 版本。

对于安装的命名空间,请确保选择了 Operator 推荐的命名空间选项。这会在

openshift-cnv命名空间中安装 Operator,该命名空间在不存在时自动创建。警告尝试在

openshift-cnv以外的命名空间中安装 OpenShift Virtualization Operator 会导致安装失败。对于 Approval Strategy,强烈建议您选择 Automatic (默认值),以便在 stable 更新频道中提供新版本时 OpenShift Virtualization 会自动更新。

虽然可以选择 Manual 批准策略,但这不可取,因为它会给集群提供支持和功能带来高风险。只有在您完全了解这些风险且无法使用 Automatic 时,才选择 Manual。

警告因为 OpenShift Virtualization 只在与对应的 OpenShift Container Platform 版本搭配使用时被支持,所以缺少的 OpenShift Virtualization 更新可能会导致您的集群不被支持。

-

点击 Install 使 Operator 可供

openshift-cnv命名空间使用。 - 当 Operator 成功安装时,点 Create HyperConverged。

- 可选: 为 OpenShift Virtualization 组件配置 Infra 和 Workloads 节点放置选项。

- 点击 Create 启动 OpenShift Virtualization。

验证

- 导航到 Workloads → Pods 页面,并监控 OpenShift Virtualization Pod,直至全部处于 Running 状态。在所有 pod 都处于 Running 状态后,您可以使用 OpenShift Virtualization。

4.2.1.2. 使用命令行安装 OpenShift Virtualization Operator

订阅 OpenShift Virtualization 目录,并通过将清单应用到集群来安装 OpenShift Virtualization Operator。

4.2.1.2.1. 使用 CLI 订阅 OpenShift virtualization 目录

在安装 OpenShift Virtualization 前,需要订阅到 OpenShift Virtualization catalog。订阅会授予 OpenShift virtualization Operator 对 openshift-cnv 命名空间的访问权限。

为了订阅,在您的集群中应用一个单独的清单(manifest)来配置 Namespace、OperatorGroup 和 Subscription 对象。

先决条件

- 在集群上安装 OpenShift Container Platform 4.16。

-

安装 OpenShift CLI (

oc) 。 -

以具有

cluster-admin特权的用户身份登录。

流程

创建一个包含以下清单的 YAML 文件:

apiVersion: v1 kind: Namespace metadata: name: openshift-cnv --- apiVersion: operators.coreos.com/v1 kind: OperatorGroup metadata: name: kubevirt-hyperconverged-group namespace: openshift-cnv spec: targetNamespaces: - openshift-cnv --- apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: hco-operatorhub namespace: openshift-cnv spec: source: redhat-operators sourceNamespace: openshift-marketplace name: kubevirt-hyperconverged startingCSV: kubevirt-hyperconverged-operator.v4.16.5 channel: "stable" 1- 1

- 使用

stable频道可确保您安装与 OpenShift Container Platform 版本兼容的 OpenShift Virtualization 版本。

运行以下命令,为 OpenShift Virtualization 创建所需的

Namespace、OperatorGroup和Subscription对象:$ oc apply -f <file name>.yaml

您可以在 YAML 文件中配置证书轮转参数。

4.2.1.2.2. 使用 CLI 部署 OpenShift Virtualization Operator

您可以使用 oc CLI 部署 OpenShift Virtualization Operator。

先决条件

-

在

openshift-cnv命名空间中订阅 OpenShift Virtualization 目录。 -

以具有

cluster-admin特权的用户身份登录。

流程

创建一个包含以下清单的 YAML 文件:

apiVersion: hco.kubevirt.io/v1beta1 kind: HyperConverged metadata: name: kubevirt-hyperconverged namespace: openshift-cnv spec:

运行以下命令来部署 OpenShift Virtualization Operator:

$ oc apply -f <file_name>.yaml

验证

通过观察

openshift-cnv命名空间中集群服务版本(CSV)的PHASE来确保 OpenShift Virtualization 已被成功部署。运行以下命令:$ watch oc get csv -n openshift-cnv

如果部署成功,则会显示以下输出:

输出示例

NAME DISPLAY VERSION REPLACES PHASE kubevirt-hyperconverged-operator.v4.16.5 OpenShift Virtualization 4.16.5 Succeeded

4.2.2. 后续步骤

- hostpath 置备程序是设计用于 OpenShift Virtualization 的本地存储置备程序。如果要为虚拟机配置本地存储,您必须首先启用 hostpath 置备程序。

4.3. 卸载 OpenShift Virtualization

您可以使用 Web 控制台或命令行界面 (CLI) 卸载 OpenShift Virtualization,以删除 OpenShift Virtualization 工作负载、Operator 及其资源。

4.3.1. 使用 Web 控制台卸载 OpenShift Virtualization

您可以使用 Web 控制台卸载 OpenShift Virtualization 来执行以下任务:

4.3.1.1. 删除 HyperConverged 自定义资源

要卸载 OpenShift Virtualization,首先删除 HyperConverged 自定义资源 (CR)。

先决条件

-

可以使用具有

cluster-admin权限的账户访问 OpenShift Container Platform 集群。

流程

- 进入到 Operators → Installed Operators 页面。

- 选择 OpenShift Virtualization Operator。

- 点 OpenShift Virtualization Deployment 选项卡。

-

点

kubevirt-hyperconverged旁边的 Options 菜单 ,然后选择 Delete HyperConverged。

,然后选择 Delete HyperConverged。

- 在确认窗口中点击 Delete。

4.3.1.2. 使用 Web 控制台从集群中删除 Operator

集群管理员可以使用 Web 控制台从所选命名空间中删除已安装的 Operator。

先决条件

-

您可以使用具有

cluster-admin权限的账户访问 OpenShift Container Platform 集群 Web 控制台。

流程

- 进入到 Operators → Installed Operators 页面。

- 在 Filter by name 字段中滚动或输入关键字以查找您要删除的 Operator。然后点它。

在 Operator Details 页面右侧,从 Actions 列表中选择 Uninstall Operator。

此时会显示 Uninstall Operator? 对话框。

选择 Uninstall 来删除 Operator、Operator 部署和 pod。按照此操作,Operator 将停止运行,不再接收更新。

注意此操作不会删除 Operator 管理的资源,包括自定义资源定义 (CRD) 和自定义资源 (CR) 。Web 控制台和继续运行的集群资源启用的仪表板和导航项可能需要手动清理。要在卸载 Operator 后删除这些,您可能需要手动删除 Operator CRD。

4.3.1.3. 使用 web 控制台删除命令空间

您可以使用 OpenShift Container Platform web 控制台删除一个命名空间。

先决条件

-

可以使用具有

cluster-admin权限的账户访问 OpenShift Container Platform 集群。

流程

- 导航至 Administration → Namespaces。

- 在命名空间列表中找到您要删除的命名空间。

-

在命名空间列表的右侧,从 Options 菜单

中选择 Delete Namespace。

中选择 Delete Namespace。

- 当 Delete Namespace 页打开时,在相关项中输入您要删除的命名空间的名称。

- 点击 Delete。

4.3.1.4. 删除 OpenShift Virtualization 自定义资源定义

您可以使用 Web 控制台删除 OpenShift Virtualization 自定义资源定义 (CRD)。

先决条件

-

可以使用具有

cluster-admin权限的账户访问 OpenShift Container Platform 集群。

流程

- 进入到 Administration → CustomResourceDefinitions。

-

选择 Label 过滤器,并在 Search 字段中输入

operators.coreos.com/kubevirt-hyperconverged.openshift-cnv,以显示 OpenShift Virtualization CRD。 -

点每个 CRD 旁边的 Options 菜单

,然后选择 Delete CustomResourceDefinition。

,然后选择 Delete CustomResourceDefinition。

4.3.2. 使用 CLI 卸载 OpenShift Virtualization

您可以使用 OpenShift CLI (oc) 卸载 OpenShift Virtualization。

先决条件

-

可以使用具有

cluster-admin权限的账户访问 OpenShift Container Platform 集群。 -

已安装 OpenShift CLI(

oc)。 - 您已删除所有虚拟机和虚拟机实例。当其工作负载保留在集群中时,您无法卸载 OpenShift Virtualization。

流程

删除

HyperConverged自定义资源:$ oc delete HyperConverged kubevirt-hyperconverged -n openshift-cnv

删除 OpenShift Virtualization Operator 订阅:

$ oc delete subscription kubevirt-hyperconverged -n openshift-cnv

删除 OpenShift Virtualization

ClusterServiceVersion资源:$ oc delete csv -n openshift-cnv -l operators.coreos.com/kubevirt-hyperconverged.openshift-cnv

删除 OpenShift Virtualization 命名空间:

$ oc delete namespace openshift-cnv

使用

dry-run选项运行oc delete crd命令列出 OpenShift Virtualization 自定义资源定义 (CRD):$ oc delete crd --dry-run=client -l operators.coreos.com/kubevirt-hyperconverged.openshift-cnv

输出示例

customresourcedefinition.apiextensions.k8s.io "cdis.cdi.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "hostpathprovisioners.hostpathprovisioner.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "hyperconvergeds.hco.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "kubevirts.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "networkaddonsconfigs.networkaddonsoperator.network.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "ssps.ssp.kubevirt.io" deleted (dry run) customresourcedefinition.apiextensions.k8s.io "tektontasks.tektontasks.kubevirt.io" deleted (dry run)

运行

oc delete crd命令来删除 CRD,而无需dry-run选项:$ oc delete crd -l operators.coreos.com/kubevirt-hyperconverged.openshift-cnv

第 5 章 安装后配置

5.1. 安装后配置

以下流程通常在安装 OpenShift Virtualization 后执行。您可以配置与环境相关的组件:

- OpenShift Virtualization Operator、工作负载和控制器的节点放置规则

网络配置 :

- 安装 Kubernetes NMState 和 SR-IOV Operator

- 配置 Linux 网桥网络以从外部访问虚拟机(VM)

- 为实时迁移配置专用的二级网络

- 配置 SR-IOV 网络

- 使用 OpenShift Container Platform Web 控制台启用创建负载均衡器服务

存储配置 :

- 为 Container Storage Interface (CSI) 定义默认存储类

- 使用 Hostpath Provisioner (HPP) 配置本地存储

5.2. 为 OpenShift Virtualization 组件指定节点

裸机节点上虚拟机(VM)的默认调度是适当的。另外,您可以通过配置节点放置规则来指定您要部署 OpenShift Virtualization Operator、工作负载和控制器的节点。

在安装 OpenShift Virtualization 后,您可以为一些组件配置节点放置规则,但如果要为工作负载配置节点放置规则,则虚拟机将无法被存在。

5.2.1. 关于 OpenShift Virtualization 组件的节点放置规则

您可以将节点放置规则用于以下任务:

- 仅在用于虚拟化工作负载的节点上部署虚拟机。

- 仅在基础架构节点上部署 Operator。

- 在工作负载之间保持隔离。

根据对象,您可以使用以下一个或多个规则类型:

nodeSelector- 允许将 Pod 调度到使用您在此字段中指定的键值对标记的节点上。节点必须具有与所有列出的对完全匹配的标签。

关联性- 可让您使用更宽松的语法来设置与 pod 匹配的规则。关联性也允许在规则应用方面更加精细。例如,您可以指定规则是首选项,而不是要求。如果规则是首选项的,则在不满足规则时仍然会调度 pod。

容限(tolerations)- 允许将 pod 调度到具有匹配污点的节点。如果某个节点有污点(taint),则该节点只接受容许该污点的 pod。

5.2.2. 应用节点放置规则

您可以使用命令行编辑 Subscription、HyperConverged 或 HostPathProvisioner 对象来应用节点放置规则。

先决条件

-

已安装

ocCLI 工具。 - 使用集群管理员权限登录。

流程

运行以下命令,在默认编辑器中编辑对象:

$ oc edit <resource_type> <resource_name> -n {CNVNamespace}- 保存文件以使改变生效。

5.2.3. 节点放置规则示例

您可以通过编辑 Subscription、HyperConverged 或 HostPathProvisioner 对象来为 OpenShift Virtualization 组件指定节点放置规则。

5.2.3.1. 订阅对象节点放置规则示例

要指定 OLM 部署 OpenShift Virtualization Operator 的节点,在 OpenShift Virtualization 安装过程中编辑 Subscription 对象。

目前,您无法使用 Web 控制台为 Subscription 对象配置节点放置规则。

Subscription 对象不支持 关联性 节点放置规则。

使用 nodeSelector 规则的 Subscription 对象示例

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: hco-operatorhub

namespace: openshift-cnv

spec:

source: redhat-operators

sourceNamespace: openshift-marketplace

name: kubevirt-hyperconverged

startingCSV: kubevirt-hyperconverged-operator.v4.16.5

channel: "stable"

config:

nodeSelector:

example.io/example-infra-key: example-infra-value 1

- 1

- OLM 在带有

example.io/example-infra-key = example-infra-value的节点上部署 OpenShift Virtualization Operator。

带有 容限 规则的 Subscription 对象示例

apiVersion: operators.coreos.com/v1alpha1

kind: Subscription

metadata:

name: hco-operatorhub

namespace: openshift-cnv

spec:

source: redhat-operators

sourceNamespace: openshift-marketplace

name: kubevirt-hyperconverged

startingCSV: kubevirt-hyperconverged-operator.v4.16.5

channel: "stable"

config:

tolerations:

- key: "key"

operator: "Equal"

value: "virtualization" 1

effect: "NoSchedule"

- 1

- OLM 在带有

key = virtualization:NoSchedule污点的节点上部署 OpenShift Virtualization Operator。只有具有匹配容限的 pod 才会调度到这些节点上。

5.2.3.2. HyperConverged 对象节点放置规则示例

要指定 OpenShift Virtualization 部署其组件的节点,您可以在 OpenShift Virtualization 安装过程中创建的 HyperConverged 自定义资源(CR)文件中编辑 nodePlacement 对象。

使用 nodeSelector 规则的 HyperConverged 对象示例

apiVersion: hco.kubevirt.io/v1beta1

kind: HyperConverged

metadata:

name: kubevirt-hyperconverged

namespace: openshift-cnv

spec:

infra:

nodePlacement:

nodeSelector:

example.io/example-infra-key: example-infra-value 1

workloads:

nodePlacement:

nodeSelector:

example.io/example-workloads-key: example-workloads-value 2

使用 关联性规则的 HyperConverged 对象示例

apiVersion: hco.kubevirt.io/v1beta1

kind: HyperConverged

metadata:

name: kubevirt-hyperconverged

namespace: openshift-cnv

spec:

infra:

nodePlacement:

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

nodeSelectorTerms:

- matchExpressions:

- key: example.io/example-infra-key

operator: In

values:

- example-infra-value 1

workloads:

nodePlacement:

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

nodeSelectorTerms:

- matchExpressions:

- key: example.io/example-workloads-key 2

operator: In

values:

- example-workloads-value

preferredDuringSchedulingIgnoredDuringExecution:

- weight: 1

preference:

matchExpressions:

- key: example.io/num-cpus

operator: Gt

values:

- 8 3

带有 容限 规则的 HyperConverged 对象示例

apiVersion: hco.kubevirt.io/v1beta1

kind: HyperConverged

metadata:

name: kubevirt-hyperconverged

namespace: openshift-cnv

spec:

workloads:

nodePlacement:

tolerations: 1

- key: "key"

operator: "Equal"

value: "virtualization"

effect: "NoSchedule"

- 1

- 为 OpenShift Virtualization 组件保留的节点使用

key = virtualization:NoSchedule污点标记。只有具有匹配容限的 pod 才会调度到保留节点上。

5.2.3.3. HostPathProvisioner 对象节点放置规则示例

您可以直接编辑 HostPathProvisioner 对象,或使用 Web 控制台。

您必须将 hostpath 置备程序和 OpenShift Virtualization 组件调度到同一节点上。否则,使用 hostpath 置备程序的虚拟化 pod 无法运行。您无法运行虚拟机。

使用 hostpath 置备程序(HPP)存储类部署虚拟机(VM)后,您可以使用节点选择器从同一节点中删除 hostpath 置备程序 pod。但是,您必须首先恢复该更改,至少针对该特定节点,并在尝试删除虚拟机前等待 pod 运行。

您可以通过为安装 hostpath 置备程序时创建的 HostPathProvisioner 对象的 spec.workload 字段指定 nodeSelector、affinity 或 tolerations 来配置节点放置规则。

带有 nodeSelector 规则的 HostPathProvisioner 对象示例

apiVersion: hostpathprovisioner.kubevirt.io/v1beta1

kind: HostPathProvisioner

metadata:

name: hostpath-provisioner

spec:

imagePullPolicy: IfNotPresent

pathConfig:

path: "</path/to/backing/directory>"

useNamingPrefix: false

workload:

nodeSelector:

example.io/example-workloads-key: example-workloads-value 1

- 1

- 工作负载放置在带有

example.io/example-workloads-key = example-workloads-value的节点上。

5.2.4. 其他资源

5.3. 安装后的网络配置

默认情况下,OpenShift Virtualization 安装了一个内部 pod 网络。

安装 OpenShift Virtualization 后,您可以安装网络 Operator 并配置额外网络。

5.3.1. 安装网络 Operator

您必须安装 Kubernetes NMState Operator 来为实时迁移或外部访问虚拟机(VM)配置 Linux 网桥网络。有关安装说明,请参阅使用 Web 控制台安装 Kubernetes NMState Operator。

您可以安装 SR-IOV Operator 来管理 SR-IOV 网络设备和网络附加。有关安装说明,请参阅安装 SR-IOV Network Operator。

您可以添加 About MetalLB 和 MetalLB Operator,以管理集群中 MetalLB 实例的生命周期。有关安装说明,请参阅使用 Web 控制台从 OperatorHub 安装 MetalLB Operator。

5.3.2. 配置 Linux 网桥网络

安装 Kubernetes NMState Operator 后,您可以为实时迁移或外部访问虚拟机(VM)配置 Linux 网桥网络。

5.3.2.1. 创建 Linux 网桥 NNCP

您可以为 Linux 网桥网络创建一个 NodeNetworkConfigurationPolicy (NNCP) 清单。

先决条件

- 已安装 Kubernetes NMState Operator。

流程

创建

NodeNetworkConfigurationPolicy清单。本例包含示例值,您必须替换为您自己的信息。apiVersion: nmstate.io/v1 kind: NodeNetworkConfigurationPolicy metadata: name: br1-eth1-policy 1 spec: desiredState: interfaces: - name: br1 2 description: Linux bridge with eth1 as a port 3 type: linux-bridge 4 state: up 5 ipv4: enabled: false 6 bridge: options: stp: enabled: false 7 port: - name: eth1 8

5.3.2.2. 使用 Web 控制台创建 Linux 网桥 NAD

您可以创建一个网络附加定义(NAD)来使用 OpenShift Container Platform web 控制台为 Pod 和虚拟机提供第 2 层网络。

Linux 网桥网络附加定义是将虚拟机连接至 VLAN 的最有效方法。

不支持在虚拟机的网络附加定义中配置 IP 地址管理(IPAM)。

流程

- 在 Web 控制台中,点 Networking → NetworkAttachmentDefinitions。

点 Create Network Attachment Definition。

注意网络附加定义必须与 pod 或虚拟机位于同一个命名空间中。

- 输入唯一 Name 和可选 Description。

- 从 Network Type 列表中选择 CNV Linux 网桥。

- 在 Bridge Name 字段输入网桥名称。

- 可选:如果资源配置了 VLAN ID,请在 VLAN Tag Number 字段中输入 ID 号。

- 可选: 选择 MAC Spoof Check 来启用 MAC spoof 过滤。此功能只允许单个 MAC 地址退出 pod,从而可以防止使用 MAC 欺骗进行的安全攻击。

- 点 Create。

5.3.3. 配置网络以进行实时迁移

配置了 Linux 网桥网络后,您可以为实时迁移配置专用网络。专用的网络可最小化实时迁移期间对租户工作负载的网络饱和影响。

5.3.3.1. 为实时迁移配置专用的二级网络

要为实时迁移配置专用的二级网络,您必须首先使用 CLI 创建桥接网络附加定义(NAD)。然后,您可以将 NetworkAttachmentDefinition 对象的名称添加到 HyperConverged 自定义资源(CR)。

先决条件

-

已安装 OpenShift CLI(

oc)。 -

您以具有

cluster-admin角色的用户身份登录到集群。 - 每个节点至少有两个网络接口卡 (NIC)。

- 用于实时迁移的 NIC 连接到同一 VLAN。

流程

根据以下示例创建

NetworkAttachmentDefinition清单:配置文件示例

apiVersion: "k8s.cni.cncf.io/v1" kind: NetworkAttachmentDefinition metadata: name: my-secondary-network 1 namespace: openshift-cnv spec: config: '{ "cniVersion": "0.3.1", "name": "migration-bridge", "type": "macvlan", "master": "eth1", 2 "mode": "bridge", "ipam": { "type": "whereabouts", 3 "range": "10.200.5.0/24" 4 } }'

运行以下命令,在默认编辑器中打开

HyperConvergedCR:oc edit hyperconverged kubevirt-hyperconverged -n openshift-cnv

将

NetworkAttachmentDefinition对象的名称添加到HyperConvergedCR 的spec.liveMigrationConfig小节中:HyperConverged清单示例apiVersion: hco.kubevirt.io/v1beta1 kind: HyperConverged metadata: name: kubevirt-hyperconverged spec: liveMigrationConfig: completionTimeoutPerGiB: 800 network: <network> 1 parallelMigrationsPerCluster: 5 parallelOutboundMigrationsPerNode: 2 progressTimeout: 150 # ...- 1

- 指定要用于实时迁移的 Multus

NetworkAttachmentDefinition对象的名称。

-

保存更改并退出编辑器。

virt-handlerPod 会重启并连接到二级网络。

验证

当运行虚拟机的节点置于维护模式时,虚拟机会自动迁移到集群中的另一个节点。您可以通过检查虚拟机实例(VMI)元数据中的目标 IP 地址,验证迁移是否在二级网络中发生,而不是默认 pod 网络。

$ oc get vmi <vmi_name> -o jsonpath='{.status.migrationState.targetNodeAddress}'

5.3.3.2. 使用 Web 控制台选择专用网络

您可以使用 OpenShift Container Platform Web 控制台为实时迁移选择一个专用网络。

先决条件

- 为实时迁移配置了 Multus 网络。

- 为网络创建了网络附加定义。

流程

- 在 OpenShift Container Platform web 控制台中进入到 Virtualization > Overview。

- 点 Settings 选项卡,然后点 Live migration。

- 从 Live migration network 列表中选择网络。

5.3.4. 配置 SR-IOV 网络

安装 SR-IOV Operator 后,您可以配置 SR-IOV 网络。

5.3.4.1. 配置 SR-IOV 网络设备

SR-IOV Network Operator 把 SriovNetworkNodePolicy.sriovnetwork.openshift.io CRD 添加到 OpenShift Container Platform。您可以通过创建一个 SriovNetworkNodePolicy 自定义资源 (CR) 来配置 SR-IOV 网络设备。

在应用由 SriovNetworkNodePolicy 对象中指定的配置时,SR-IOV Operator 可能会排空节点,并在某些情况下会重启节点。仅在以下情况下重启:

-

使用 Mellanox NIC (

mlx5驱动程序) 时,每次当在一个物理功能(PF)中的虚拟功能 (VF) 数量增加时,节点都会重启。 -

使用 Intel NIC 时,只有在内核参数不包含

intel_iommu=on和iommu=pt时,才会重启。

它可能需要几分钟时间来应用配置更改。

先决条件

-

已安装 OpenShift CLI(

oc)。 -

您可以使用具有

cluster-admin角色的用户访问集群。 - 已安装 SR-IOV Network Operator。

- 集群中有足够的可用节点,用于处理从排空节点中驱除的工作负载。

- 您还没有为 SR-IOV 网络设备配置选择任何 control plane 节点。

流程

创建一个

SriovNetworkNodePolicy对象,然后在<name>-sriov-node-network.yaml文件中保存 YAML。使用配置的实际名称替换<name>。apiVersion: sriovnetwork.openshift.io/v1 kind: SriovNetworkNodePolicy metadata: name: <name> 1 namespace: openshift-sriov-network-operator 2 spec: resourceName: <sriov_resource_name> 3 nodeSelector: feature.node.kubernetes.io/network-sriov.capable: "true" 4 priority: <priority> 5 mtu: <mtu> 6 numVfs: <num> 7 nicSelector: 8 vendor: "<vendor_code>" 9 deviceID: "<device_id>" 10 pfNames: ["<pf_name>", ...] 11 rootDevices: ["<pci_bus_id>", "..."] 12 deviceType: vfio-pci 13 isRdma: false 14

- 1

- 为 CR 对象指定一个名称。

- 2

- 指定 SR-IOV Operator 安装到的命名空间。

- 3

- 指定 SR-IOV 设备插件的资源名称。您可以为一个资源名称创建多个

SriovNetworkNodePolicy对象。 - 4

- 指定节点选择器来选择要配置哪些节点。只有所选节点上的 SR-IOV 网络设备才会被配置。SR-IOV Container Network Interface(CNI)插件和设备插件仅在所选节点上部署。

- 5

- 可选:指定一个

0到99之间的整数。较小的数值具有较高的优先权,优先级10高于优先级99。默认值为99。 - 6

- 可选:为虚拟功能(VF)的最大传输单位 (MTU) 指定一个值。最大 MTU 值可能因不同的 NIC 型号而有所不同。

- 7

- 为 SR-IOV 物理网络设备指定要创建的虚拟功能 (VF) 的数量。对于 Intel 网络接口控制器(NIC),VF 的数量不能超过该设备支持的 VF 总数。对于 Mellanox NIC,VF 的数量不能超过

127。 - 8

nicSelector映射为 Operator 选择要配置的以太网设备。您不需要为所有参数指定值。建议您以足够的准确度来识别以太网适配器,以便尽量减小意外选择其他以太网设备的可能性。如果指定了rootDevices,则必须同时为vendor、deviceID或pfNames指定一个值。如果同时指定了pfNames和rootDevices,请确保它们指向同一个设备。- 9

- 可选:指定 SR-IOV 网络设备的厂商十六进制代码。允许的值只能是

8086或15b3。 - 10

- 可选:指定 SR-IOV 网络设备的设备十六进制代码。允许的值只能是

158b、1015、1017。 - 11

- 可选:参数接受包括以太网设备的一个或多个物理功能 (PF) 的数组。

- 12

- 参数接受一个包括一个或多个 PCI 总线地址,用于以太网设备的物理功能的数组。使用以下格式提供地址:

0000:02:00.1。 - 13

- OpenShift Virtualization 中的虚拟功能需要

vfio-pci驱动程序类型。 - 14

- 可选:指定是否启用远程直接访问(RDMA)模式。对于 Mellanox 卡,请将

isRdma设置为false。默认值为false。

注意如果将

RDMA标记设定为true,您可以继续使用启用了 RDMA 的 VF 作为普通网络设备。设备可在其中的一个模式中使用。-

可选:将 SR-IOV 功能的集群节点标记为

SriovNetworkNodePolicy.Spec.NodeSelector(如果它们还没有标记)。有关标记节点的更多信息,请参阅"了解如何更新节点上的标签"。 创建

SriovNetworkNodePolicy对象:$ oc create -f <name>-sriov-node-network.yaml

其中

<name>指定这个配置的名称。在应用配置更新后,

sriov-network-operator命名空间中的所有 Pod 都会变为Running状态。要验证是否已配置了 SR-IOV 网络设备,请输入以下命令。将

<node_name>替换为带有您刚才配置的 SR-IOV 网络设备的节点名称。$ oc get sriovnetworknodestates -n openshift-sriov-network-operator <node_name> -o jsonpath='{.status.syncStatus}'

5.3.5. 使用 Web 控制台启用负载均衡器服务创建

您可以使用 OpenShift Container Platform web 控制台为虚拟机(VM)创建负载均衡器服务。

先决条件

- 已为集群配置负载均衡器。

-

以具有

cluster-admin角色的用户身份登录。 - 为网络创建了网络附加定义。

流程

- 进入到 Virtualization → Overview。

- 在 Settings 选项卡中,点 Cluster。

- 展开 General settings 和 SSH 配置。

- 将 SSH over LoadBalancer 服务 设置为 on。

5.4. 安装后存储配置

以下存储配置任务是必需的:

可选: 您可以使用 hostpath 置备程序(HPP)配置本地存储。

如需了解更多选项,请参阅 存储配置概述,包括配置 Containerized Data Importer (CDI)、数据卷和自动引导源更新。

5.4.1. 使用 HPP 配置本地存储

安装 OpenShift Virtualization Operator 时,会自动安装 Hostpath Provisioner(HPP)Operator。HPP Operator 创建 HPP 置备程序。

HPP 是为 OpenShift Virtualization 设计的本地存储置备程序。要使用 HPP,您必须创建一个 HPP 自定义资源(CR)。

HPP 存储池不能与操作系统位于同一个分区。否则,存储池可能会填满操作系统分区。如果操作系统分区已满,则性能可能会生效,或者节点可能会不稳定或不可用。

5.4.1.1. 使用 storagePools 小节为 CSI 驱动程序创建存储类

要使用 hostpath 置备程序 (HPP),您必须为 Container Storage Interface (CSI) 驱动程序创建关联的存储类。

当您创建存储类时,您将设置参数,它们会影响属于该存储类的持久性卷(PV)的动态置备。您不能在创建 StorageClass 对象后更新其参数。

虚拟机使用基于本地 PV 的数据卷。本地 PV 与特定节点绑定。虽然磁盘镜像准备供虚拟机消耗,但可能不会将虚拟机调度到之前固定本地存储 PV 的节点。

要解决这个问题,使用 Kubernetes pod 调度程序将持久性卷声明(PVC)绑定到正确的节点上的 PV。通过使用 volumeBindingMode 参数设置为 WaitForFirstConsumer 的 StorageClass 值,PV 的绑定和置备会延迟到 pod 使用 PVC。

流程

创建

storageclass_csi.yaml文件来定义存储类:apiVersion: storage.k8s.io/v1 kind: StorageClass metadata: name: hostpath-csi provisioner: kubevirt.io.hostpath-provisioner reclaimPolicy: Delete 1 volumeBindingMode: WaitForFirstConsumer 2 parameters: storagePool: my-storage-pool 3

- 保存文件并退出。

运行以下命令来创建

StorageClass对象:$ oc create -f storageclass_csi.yaml

5.5. 配置更高的虚拟机工作负载密度

要增加虚拟机 (VM) 的数量,您可以通过过量使用内存 (RAM) 来在集群中配置更高的虚拟机工作负载密度。

配置更高的工作负载密度只是一个技术预览功能。技术预览功能不受红帽产品服务等级协议(SLA)支持,且功能可能并不完整。红帽不推荐在生产环境中使用它们。这些技术预览功能可以使用户提早试用新的功能,并有机会在开发阶段提供反馈意见。

有关红帽技术预览功能支持范围的更多信息,请参阅技术预览功能支持范围。

以下工作负载特别适用于更高的工作负载密度:

- 许多类似的工作负载

- 低使用的工作负载

虽然过度使用的内存可能会导致工作负载密度更高,但也可能会降低高使用系统的工作负载性能。

5.5.1. 使用 wasp-agent 来配置更高的虚拟机工作负载密度

wasp-agent 组件允许 OpenShift Container Platform 集群为虚拟机(VM) 工作负载分配交换资源。只有在 worker 节点上才支持交换使用量。

交换资源只能分配给 Burstable 服务质量 (QoS) 类的虚拟机工作负载 (VM pod)。属于虚拟机的 Guaranteed QoS 类和任何 QoS 类的 pod 不能交换资源。

有关 QoS 类的描述,请参阅为 Pod 配置服务质量 (Kubernetes 文档)。

先决条件

-

oc工具可用。 - 使用 cluster-admin 角色登录到集群。

- 定义内存 over-commit 比率。

- 节点属于 worker 池。

流程

输入以下命令来创建特权服务帐户:

$ oc adm new-project wasp

$ oc create sa -n wasp wasp

$ oc create clusterrolebinding wasp --clusterrole=cluster-admin --serviceaccount=wasp:wasp

$ oc adm policy add-scc-to-user -n wasp privileged -z wasp

注意wasp-agent组件部署 OCI hook,以便在节点级别上为容器启用交换使用情况。低级性质要求DaemonSet对象具有特权。通过创建

DaemonSet对象来部署wasp-agent,如下所示:kind: DaemonSet apiVersion: apps/v1 metadata: name: wasp-agent namespace: wasp labels: app: wasp tier: node spec: selector: matchLabels: name: wasp template: metadata: annotations: description: >- Configures swap for workloads labels: name: wasp spec: serviceAccountName: wasp hostPID: true hostUsers: true terminationGracePeriodSeconds: 5 containers: - name: wasp-agent image: >- registry.redhat.io/container-native-virtualization/wasp-agent-rhel9:v4.16 imagePullPolicy: Always env: - name: "FSROOT" value: "/host" resources: requests: cpu: 100m memory: 50M securityContext: privileged: true volumeMounts: - name: host mountPath: "/host" volumes: - name: host hostPath: path: "/" priorityClassName: system-node-critical updateStrategy: type: RollingUpdate rollingUpdate: maxUnavailable: 10% maxSurge: 0 status: {}将

kubelet服务配置为允许交换:如示例所示,创建一个

KubeletConfiguration文件:KubeletConfiguration文件示例apiVersion: machineconfiguration.openshift.io/v1 kind: KubeletConfig metadata: name: custom-config spec: machineConfigPoolSelector: matchLabels: pools.operator.machineconfiguration.openshift.io/worker: '' # MCP #machine.openshift.io/cluster-api-machine-role: worker # machine #node-role.kubernetes.io/worker: '' # node kubeletConfig: failSwapOn: false evictionSoft: memory.available: "1Gi" evictionSoftGracePeriod: memory.available: "10s"如果集群已使用现有的

KubeletConfiguration文件,请将以下内容添加到spec部分:apiVersion: machineconfiguration.openshift.io/v1 kind: KubeletConfig metadata: name: custom-config # ... spec # ... kubeletConfig: evictionSoft: memory.available: 1Gi evictionSoftGracePeriod: memory.available: 1m30s failSwapOn: false运行以下命令:

$ oc wait mcp worker --for condition=Updated=True

创建

MachineConfig对象以置备交换,如下所示:apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: worker name: 90-worker-swap spec: config: ignition: version: 3.4.0 systemd: units: - contents: | [Unit] Description=Provision and enable swap ConditionFirstBoot=no [Service] Type=oneshot Environment=SWAP_SIZE_MB=5000 ExecStart=/bin/sh -c "sudo dd if=/dev/zero of=/var/tmp/swapfile count=${SWAP_SIZE_MB} bs=1M && \ sudo chmod 600 /var/tmp/swapfile && \ sudo mkswap /var/tmp/swapfile && \ sudo swapon /var/tmp/swapfile && \ free -h && \ sudo systemctl set-property --runtime system.slice MemorySwapMax=0 IODeviceLatencyTargetSec=\"/ 50ms\"" [Install] RequiredBy=kubelet-dependencies.target enabled: true name: swap-provision.service为了在出现最糟糕的情况时有足够的交换空间,请确保置备的交换空间的数量最少与过量使用 RAM 相同。使用以下公式计算节点上置备的交换空间量:

NODE_SWAP_SPACE = NODE_RAM * (MEMORY_OVER_COMMIT_PERCENT / 100% - 1)

Example:

NODE_SWAP_SPACE = 16 GB * (150% / 100% - 1) = 16 GB * (1.5 - 1) = 16 GB * (0.5) = 8 GB按如下方式部署警报规则:

apiVersion: monitoring.openshift.io/v1 kind: AlertingRule metadata: name: wasp-alerts namespace: openshift-monitoring spec: groups: - name: wasp.rules rules: - alert: NodeSwapping annotations: description: Node {{ $labels.instance }} is swapping at a rate of {{ printf "%.2f" $value }} MB/s runbook_url: https://github.com/openshift-virtualization/wasp-agent/tree/main/runbooks/alerts/NodeSwapping.md summary: A node is swapping memory pages expr: | # In MB/s irate(node_memory_SwapFree_bytes{job="node-exporter"}[5m]) / 1024^2 > 0 for: 1m labels: severity: critical使用 OpenShift Container Platform Web 控制台或编辑 HyperConverged 自定义资源 (CR) 文件,将 OpenShift Virtualization 配置为使用内存过量使用,如下例所示。

Example:

apiVersion: hco.kubevirt.io/v1beta1 kind: HyperConverged metadata: name: kubevirt-hyperconverged namespace: openshift-cnv spec: higherWorkloadDensity: memoryOvercommitPercentage: 150输入以下命令将所有配置应用到集群中的计算节点:

$ oc patch --type=merge \ -f <../manifests/hco-set-memory-overcommit.yaml> \ --patch-file <../manifests/hco-set-memory-overcommit.yaml>

注意应用所有配置后,交换功能仅在所有

MachineConfigPoolrollouts 完成后完全可用。

验证

要验证

wasp-agent的部署,请运行以下命令:$ oc rollout status ds wasp-agent -n wasp

如果部署成功,则会显示以下信息:

daemon set "wasp-agent" successfully rolled out

要验证是否正确置备了 swap,请执行以下操作:

运行以下命令:

$ oc get nodes -l node-role.kubernetes.io/worker

从提供的列表中选择节点并运行以下命令:

$ oc debug node/<selected-node> -- free -m

如果正确置备了 swap,则会显示大于零的数量,如下所示:

total

使用的

free

shared

buff/cache

可用

Mem:

31846

23155

1044

6014

14483

8690

Swap:

8191

2337

5854

运行以下命令验证 OpenShift Virtualization 内存过量使用配置:

$ oc get -n openshift-cnv HyperConverged kubevirt-hyperconverged -o jsonpath="{.spec.higherWorkloadDensity.memoryOvercommitPercentage}" 150返回的值(如

150)必须与之前配置的值匹配。

第 6 章 更新

6.1. 更新 OpenShift Virtualization

了解 Operator Lifecycle Manager (OLM) 如何为 OpenShift Virtualization 提供 z-stream 和次要版本更新。

6.1.1. RHEL 9 上的 OpenShift Virtualization

OpenShift Virtualization 4.16 基于 Red Hat Enterprise Linux (RHEL) 9。您可以按照标准 OpenShift Virtualization 更新过程,从一个基于 RHEL 8 的版本升级到 OpenShift Virtualization 4.16。不需要额外的步骤。

与之前的版本一样,您可以在不中断运行工作负载的情况下执行更新。OpenShift Virtualization 4.16 支持从 RHEL 8 节点实时迁移到 RHEL 9 节点。

6.1.1.1. RHEL 9 机器类型

OpenShift Virtualization 中包含的所有虚拟机模板现在默认使用 RHEL 9 机器类型: machineType: pc-q35-rhel9.<y>.0,其中 <y> 是与最新 RHEL 9 次版本对应的数字。例如,值 pc-q35-rhel9.2.0 用于 RHEL 9.2。

更新 OpenShift Virtualization 不会更改任何现有虚拟机的 machineType 值。这些虚拟机在更新前继续正常工作。您可以选择更改虚拟机的机器类型,使其可从 RHEL 9 改进中受益。

在更改虚拟机的 machineType 值前,您必须关闭虚拟机。

6.1.2. 关于更新 OpenShift Virtualization

- Operator Lifecycle Manager (OLM) 管理 OpenShift Virtualization Operator 的生命周期。Marketplace Operator 在 OpenShift Container Platform 安装过程中部署,使外部 Operator 可供集群使用。

- OLM 为 OpenShift Virtualization 提供 z-stream 和次要版本更新。在将 OpenShift Container Platform 更新至下一个次版本时,次版本更新将变为可用。在不先更新 OpenShift Container Platform 的情况下,您无法将 OpenShift Virtualization 更新至下一个次版本。

- OpenShift Virtualization 订阅使用一个名为 stable 的单一更新频道。stable 频道确保 OpenShift Virtualization 和 OpenShift Container Platform 版本兼容。

如果您的订阅的批准策略被设置为 Automatic,则当 stable 频道中提供新版本的 Operator 时,更新过程就会马上启动。强烈建议您使用 Automatic(自动) 批准策略来维护可支持的环境。只有在运行对应的 OpenShift Container Platform 版本时,才会支持 OpenShift Virtualization 的每个次要版本。例如,您必须在 OpenShift Container Platform 4.16 上运行 OpenShift Virtualization 4.16。

- 虽然可以选择 Manual(手工) 批准策略,但并不建议这样做,因为它存在集群的支持性和功能风险。使用 Manual 批准策略时,您必须手动批准每个待处理的更新。如果 OpenShift Container Platform 和 OpenShift Virtualization 更新不同步,您的集群将无法被支持。

- 更新完成所需时间取决于您的网络连接情况。大部分自动更新可在十五分钟内完成。

- 更新 OpenShift Virtualization 不会中断网络连接。

- 数据卷及其关联的持久性卷声明会在更新过程中保留。

如果您的虚拟机正在运行,使用 hostpath 置备程序存储,则无法实时迁移,并可能会阻止 OpenShift Container Platform 集群更新。

作为临时解决方案,您可以重新配置虚拟机以便在集群更新过程中自动关闭它们。将 evictionStrategy 字段设置为 None,将 runStrategy 字段设置为 Always。

6.1.2.1. 关于工作负载更新

更新 OpenShift Virtualization 时,虚拟机工作负载(包括 libvirt、virt-launcher )和 qemu (如果支持实时迁移)会自动更新。

每个虚拟机均有一个 virt-launcher pod,用于运行虚拟机实例(VMI)。virt-launcher pod 运行一个 libvirt 实例,用于管理虚拟机(VM)进程。

您可以通过编辑 HyperConverged 自定义资源 (CR) 的 spec.workloadUpdateStrategy 小节来配置工作负载的更新方式。可用的工作负载更新方法有两种: LiveMigrate 和 Evict。

因为 Evict 方法关闭 VMI pod,所以只启用 LiveMigrate 更新策略。

当 LiveMigrate 是唯一启用的更新策略时:

- 支持实时迁移的 VMI 会在更新过程中进行迁移。VM 客户机会进入启用了更新组件的新 pod。

不支持实时迁移的 VMI 不会中断或更新。

-

如果 VMI 有

LiveMigrate驱除策略,但没有支持实时迁移。

-

如果 VMI 有

如果您同时启用 LiveMigrate 和 Evict :

-

支持实时迁移的 VMI 使用

LiveMigrate更新策略。 -

不支持实时迁移的 VMI 使用

Evict更新策略。如果 VMI 由带有runStrategy: Always设置的VirtualMachine对象控制,则会在带有更新组件的新 pod 中创建一个新的 VMI。

迁移尝试和超时

更新工作负载时,如果 pod 在以下时间段内处于 Pending 状态,实时迁移会失败:

- 5 分钟

-

如果 pod 因为是

Unschedulable而处于 pending 状态。 - 15 分钟

- 如果 pod 因任何原因处于 pending 状态。

当 VMI 无法迁移时,virt-controller 会尝试再次迁移它。它会重复这个过程,直到所有可可迁移的 VMI 在新的 virt-launcher Pod 上运行。如果 VMI 没有被正确配置,这些尝试可能会无限期重复。

每次尝试都会对应于一个迁移对象。只有最近五个尝试才在缓冲区中。这可防止迁移对象在系统上进行积累,同时保留用于调试的信息。

6.1.2.2. 关于 Control Plane Only 更新

每个 OpenShift Container Platform 的次版本号为偶数(包括 4.10 和 4.12)都是延长更新支持(EUS)版本。但是,由于 Kubernetes 设计了串行次版本更新,所以您无法直接从一个 EUS 版本更新到下一个版本。

从源 EUS 版本升级到下一个奇数次版本后,您必须按顺序将 OpenShift Virtualization 更新至更新路径中的所有次版本的 z-stream 版本。当您升级到最新的适用 z-stream 版本时,您可以将 OpenShift Container Platform 更新至目标 EUS 次版本。

当 OpenShift Container Platform 更新成功时,OpenShift Virtualization 的对应更新将变为可用。现在,您可以将 OpenShift Virtualization 更新至目标 EUS 版本。

6.1.2.2.1. 准备更新

在开始 Control Plane Only 更新前,您必须:

- 在启动 Control Plane Only 更新前,暂停 worker 节点的机器配置池,以便 worker 不会重启两次。

- 在开始更新过程前禁用自动工作负载更新。这是为了防止 OpenShift Virtualization 迁移或驱除虚拟机(VM),直到您升级到目标 EUS 版本。

默认情况下,当您更新 OpenShift Virtualization Operator 时,OpenShift Virtualization 会自动更新工作负载,如 virt-launcher pod。您可以在 HyperConverged 自定义资源的 spec.workloadUpdateStrategy 小节中配置此行为。

了解有关 执行 Control Plane Only 更新的更多信息。

6.1.3. 防止在 Control Plane Only 更新过程中进行工作负载更新

当您从一个延长更新支持(EUS)版本升级到下一个版本时,您必须手动禁用自动工作负载更新,以防止 OpenShift Virtualization 在更新过程中迁移或驱除工作负载。

先决条件

- 您正在运行 EUS 版本 OpenShift Container Platform,并希望升级到下一个 EUS 版本。还没有同时更新至奇数版本。

- 您可以阅读"准备执行 Control Plane only update",并了解与 OpenShift Container Platform 集群相关的注意事项和要求。

- 按照 OpenShift Container Platform 文档的指示暂停 worker 节点的机器配置池。

- 建议您使用默认的 Automatic 批准策略。如果使用 Manual 批准策略,您必须批准 web 控制台中的所有待处理的更新。如需了解更多详细信息,请参阅"需要批准待处理的 Operator 更新"部分。

流程

运行以下命令并记录

workloadUpdateMethods配置:$ oc get kv kubevirt-kubevirt-hyperconverged \ -n openshift-cnv -o jsonpath='{.spec.workloadUpdateStrategy.workloadUpdateMethods}'运行以下命令关闭所有工作负载更新方法:

$ oc patch hyperconverged kubevirt-hyperconverged -n openshift-cnv \ --type json -p '[{"op":"replace","path":"/spec/workloadUpdateStrategy/workloadUpdateMethods", "value":[]}]'输出示例

hyperconverged.hco.kubevirt.io/kubevirt-hyperconverged patched

在继续操作前,请确保

HyperConvergedOperator 为Upgradeable。输入以下命令并监控输出:$ oc get hyperconverged kubevirt-hyperconverged -n openshift-cnv -o json | jq ".status.conditions"

例 6.1. 输出示例

[ { "lastTransitionTime": "2022-12-09T16:29:11Z", "message": "Reconcile completed successfully", "observedGeneration": 3, "reason": "ReconcileCompleted", "status": "True", "type": "ReconcileComplete" }, { "lastTransitionTime": "2022-12-09T20:30:10Z", "message": "Reconcile completed successfully", "observedGeneration": 3, "reason": "ReconcileCompleted", "status": "True", "type": "Available" }, { "lastTransitionTime": "2022-12-09T20:30:10Z", "message": "Reconcile completed successfully", "observedGeneration": 3, "reason": "ReconcileCompleted", "status": "False", "type": "Progressing" }, { "lastTransitionTime": "2022-12-09T16:39:11Z", "message": "Reconcile completed successfully", "observedGeneration": 3, "reason": "ReconcileCompleted", "status": "False", "type": "Degraded" }, { "lastTransitionTime": "2022-12-09T20:30:10Z", "message": "Reconcile completed successfully", "observedGeneration": 3, "reason": "ReconcileCompleted", "status": "True", "type": "Upgradeable" 1 } ]- 1

- OpenShift Virtualization Operator 具有

Upgradeable状态。

手动将集群从源 EUS 版本升级到下一个 OpenShift Container Platform 次要版本:

$ oc adm upgrade

验证

运行以下命令检查当前版本:

$ oc get clusterversion

注意将 OpenShift Container Platform 更新至下一版本是更新 OpenShift Virtualization 的先决条件。如需了解更多详细信息,请参阅 OpenShift Container Platform 文档中的"更新集群"部分。

更新 OpenShift Virtualization。

- 使用默认的 Automatic 批准策略,OpenShift Virtualization 会在更新 OpenShift Container Platform 后自动更新到对应的版本。

- 如果使用 Manual 批准策略,请使用 Web 控制台批准待处理的更新。

运行以下命令监控 OpenShift Virtualization 更新:

$ oc get csv -n openshift-cnv

- 将 OpenShift Virtualization 更新至可用于非 EUS 次版本的每个 z-stream 版本,通过运行上一步中显示的命令来监控每个更新。

运行以下命令,确认 OpenShift Virtualization 已成功更新至非 EUS 版本的最新 z-stream 版本:

$ oc get hyperconverged kubevirt-hyperconverged -n openshift-cnv -o json | jq ".status.versions"

输出示例

[ { "name": "operator", "version": "4.16.5" } ]等待

HyperConvergedOperator 在执行下一次更新前具有Upgradeable状态。输入以下命令并监控输出:$ oc get hyperconverged kubevirt-hyperconverged -n openshift-cnv -o json | jq ".status.conditions"

- 将 OpenShift Container Platform 更新至目标 EUS 版本。

通过检查集群版本确认更新是否成功:

$ oc get clusterversion

将 OpenShift Virtualization 更新至目标 EUS 版本。

- 使用默认的 Automatic 批准策略,OpenShift Virtualization 会在更新 OpenShift Container Platform 后自动更新到对应的版本。

- 如果使用 Manual 批准策略,请使用 Web 控制台批准待处理的更新。

运行以下命令监控 OpenShift Virtualization 更新:

$ oc get csv -n openshift-cnv

当

VERSION字段与目标 EUS 版本匹配并且PHASE字段显示为Succeeded时,更新已完成。使用以下命令恢复您从第 1 步中记录的

workloadUpdateMethods配置:$ oc patch hyperconverged kubevirt-hyperconverged -n openshift-cnv --type json -p \ "[{\"op\":\"add\",\"path\":\"/spec/workloadUpdateStrategy/workloadUpdateMethods\", \"value\":{WorkloadUpdateMethodConfig}}]"输出示例

hyperconverged.hco.kubevirt.io/kubevirt-hyperconverged patched

验证

运行以下命令检查虚拟机迁移的状态:

$ oc get vmim -A

后续步骤

- 现在,您可以取消暂停 worker 节点的机器配置池。

6.1.4. 配置工作负载更新方法

您可以通过编辑 HyperConverged 自定义资源(CR)来配置工作负载更新方法。

先决条件

要使用实时迁移作为更新方法,您必须首先在集群中启用实时迁移。

注意如果

VirtualMachineInstanceCR 包含evictionStrategy: LiveMigrate,且虚拟机实例(VMI)不支持实时迁移,则 VMI 将不会更新。

流程

要在默认编辑器中打开

HyperConvergedCR,请运行以下命令:$ oc edit hyperconverged kubevirt-hyperconverged -n openshift-cnv

编辑

HyperConvergedCR 的workloadUpdateStrategy小节。例如:apiVersion: hco.kubevirt.io/v1beta1 kind: HyperConverged metadata: name: kubevirt-hyperconverged spec: workloadUpdateStrategy: workloadUpdateMethods: 1 - LiveMigrate 2 - Evict 3 batchEvictionSize: 10 4 batchEvictionInterval: "1m0s" 5 # ...- 1

- 可用于执行自动化工作负载更新的方法。可用值为

LiveMigrate和Evict。如果您如本例所示启用这两个选项,则更新会为不支持实时迁移的 VMI 使用LiveMigrate,对于不支持实时迁移的 VMI 使用Evict。要禁用自动工作负载更新,您可以删除workloadUpdateStrategy小节,或设置workloadUpdateMethods: []将数组留空。 - 2

- 具有最低破坏性的更新方法。支持实时迁移的 VMI 通过将虚拟机 (VM) 客户机迁移到启用了更新组件的新 pod 中来更新。如果

LiveMigrate是唯一列出的工作负载更新方法,不支持实时迁移的 VMI 不会中断或更新。 - 3

- 在升级过程中关闭 VMI pod 是一个有破坏性的方法。如果在集群中没有启用实时迁移,

Evict是唯一可用的更新方法。如果 VMI 由带有runStrategy: Always配置的VirtualMachine对象控制,则会在带有更新组件的新 pod 中创建一个新的 VMI。 - 4

- 使用

Evict方法每次可以强制更新的 VMI 数量。这不适用于LiveMigrate方法。 - 5

- 驱除下一批工作负载前等待的时间间隔。这不适用于

LiveMigrate方法。

注意您可以通过编辑

HyperConvergedCR 的spec.liveMigrationConfig小节来配置实时迁移限制和超时。- 若要应用您的更改,请保存并退出编辑器。

6.1.5. 批准待处理的 Operator 更新

6.1.5.1. 手动批准待处理的 Operator 更新

如果已安装的 Operator 的订阅被设置为 Manual,则当其当前更新频道中发布新更新时,在开始安装前必须手动批准更新。

先决条件

- 之前使用 Operator Lifecycle Manager(OLM)安装的 Operator。

流程

- 在 OpenShift Container Platform Web 控制台的 Administrator 视角中,进入 Operators → Installed Operators。

- 处于待定更新的 Operator 会显示 Upgrade available 状态。点您要更新的 Operator 的名称。

- 点 Subscription 标签页。任何需要批准的更新都会在 Upgrade status 旁边显示。例如:它可能会显示 1 requires approval。

- 点 1 requires approval,然后点 Preview Install Plan。

- 检查列出可用于更新的资源。在满意后,点 Approve。

- 返回到 Operators → Installed Operators 页面,以监控更新的进度。完成后,状态会变为 Succeeded 和 Up to date。

6.1.6. 监控更新状态

6.1.6.1. 监控 OpenShift Virtualization 升级状态

要监控 OpenShift Virtualization Operator 升级的状态,请观察集群服务版本 (CSV) PHASE。此外您还可在 web 控制台中,或运行此处提供的命令来监控 CSV 状况。

PHASE 和状况值均是基于可用信息的近似值。

先决条件

-

以具有

cluster-admin角色的用户身份登录集群。 -

安装 OpenShift CLI(

oc)。

流程

运行以下命令:

$ oc get csv -n openshift-cnv

查看输出,检查

PHASE字段。例如:输出示例

VERSION REPLACES PHASE 4.9.0 kubevirt-hyperconverged-operator.v4.8.2 Installing 4.9.0 kubevirt-hyperconverged-operator.v4.9.0 Replacing

可选:运行以下命令来监控所有 OpenShift Virtualization 组件状况的聚合状态:

$ oc get hyperconverged kubevirt-hyperconverged -n openshift-cnv \ -o=jsonpath='{range .status.conditions[*]}{.type}{"\t"}{.status}{"\t"}{.message}{"\n"}{end}'成功升级后会输出以下内容:

输出示例

ReconcileComplete True Reconcile completed successfully Available True Reconcile completed successfully Progressing False Reconcile completed successfully Degraded False Reconcile completed successfully Upgradeable True Reconcile completed successfully

6.1.6.2. 查看过时的 OpenShift Virtualization 工作负载

您可以使用 CLI 查看过时的工作负载列表。

如果集群中存在过时的虚拟化 pod,OutdatedVirtualMachineInstanceWorkloads 警报会触发。

流程

要查看过时的虚拟机实例 (VMI) 列表,请运行以下命令:

$ oc get vmi -l kubevirt.io/outdatedLauncherImage --all-namespaces

配置工作负载更新以确保 VMI 自动更新。

6.1.7. 其他资源

第 7 章 虚拟机

7.1. 从红帽镜像创建虚拟机

7.1.1. 从红帽镜像创建虚拟机概述

红帽镜像是金级镜像。它们作为容器磁盘在安全 registry 中发布。Containerized Data Importer (CDI) 轮询容器磁盘并将其导入到集群中,并将其存储在 openshift-virtualization-os-images 项目中作为快照或持久性卷声明(PVC)。

红帽镜像会自动更新。您可以为这些镜像禁用和重新启用自动更新。请参阅管理红帽引导源更新。

集群管理员现在可以在 OpenShift Virtualization web 控制台中为 Red Hat Enterprise Linux (RHEL)虚拟机启用自动订阅。

您可以使用以下方法之一从红帽提供的操作系统镜像创建虚拟机(VM):

不要在默认的 openshift Galaxy 命名空间中创建虚拟机。相反,创建一个新命名空间或使用没有 openshift 前缀的现有命名空间。

7.1.1.1. 关于金级镜像

金级镜像是虚拟机(VM)的预配置快照,您可以用作部署新虚拟机的资源。例如,您可以使用金级镜像来更加一致地置备相同的系统环境,并更快高效地部署系统。

7.1.1.1.1. 金级镜像如何工作?

通过在参考机器或虚拟机上安装和配置操作系统和软件应用程序来创建金级镜像。这包括设置系统、安装所需的驱动程序、应用补丁和更新以及配置特定选项和首选项。

创建金级镜像后,它会保存为模板或镜像文件,可在多个集群中复制和部署。金级镜像可以通过维护人员定期更新,以纳入必要的软件更新和补丁,确保镜像保持最新且安全,并且新创建的虚拟机基于这个更新的镜像。

7.1.1.1.2. 红帽对金级镜像的实施

对于 Red Hat Enterprise Linux (RHEL) 版本,红帽发布金级镜像作为 registry 中的容器磁盘。容器磁盘是虚拟机镜像,它作为容器镜像 registry 存储在容器镜像 registry 中。安装 OpenShift Virtualization 后,任何发布的镜像将自动在连接的集群中提供。镜像在集群中可用后,可以使用它们创建虚拟机。

7.1.1.2. 关于虚拟机引导源

虚拟机 (VM) 由虚拟机定义以及由数据卷支持的一个或多个磁盘组成。VM 模板允许您使用预定义的规格创建虚拟机。

每个模板都需要一个引导源,它是一个完全配置的磁盘镜像,包括配置的驱动程序。每个模板都包含一个虚拟机定义,其中包含指向引导源的指针。每个引导源都有一个预定义的名称和命名空间。对于某些操作系统,会自动提供一个引导源。如果没有提供,管理员必须准备自定义引导源。

提供的引导源会自动更新至操作系统的最新版本。对于自动更新的引导源,持久性卷声明 (PVC) 和卷快照会使用集群的默认存储类创建。如果在配置后选择了不同的默认存储类,您必须删除使用之前默认存储类配置的集群命名空间中的现有引导源。

7.1.2. 从实例类型创建虚拟机

您可以使用实例类型(无论 OpenShift Container Platform web 控制台或 CLI 创建虚拟机)来简化虚拟机 (VM) 创建。

7.1.2.1. 关于实例类型

实例类型是一种可重复使用的对象,您可以定义应用到新虚拟机的资源和特征。您可以定义自定义实例类型,或使用安装 OpenShift Virtualization 时包括的各种类型。

要创建新实例类型,您必须首先手动创建清单,也可以使用 virtctl CLI 工具创建清单。然后,您可以通过将清单应用到集群来创建实例类型对象。

OpenShift Virtualization 为配置实例类型提供两个 CRD:

-

命名空间范围对象:

VirtualMachineInstancetype -

集群范围的对象:

VirtualMachineClusterInstancetype

这些对象使用相同的 VirtualMachineInstancetypeSpec。

7.1.2.1.1. 所需属性

配置实例类型时,您必须定义 cpu 和 memory 属性。其他属性是可选的。

从实例类型创建虚拟机时,您无法覆盖实例类型中定义的任何参数。

因为实例类型需要定义的 CPU 和内存属性,所以 OpenShift Virtualization 始终会在从实例类型创建虚拟机时拒绝这些资源的额外请求。

您可以手动创建实例类型清单。例如:

带有必填字段的 YAML 文件示例

apiVersion: instancetype.kubevirt.io/v1beta1

kind: VirtualMachineInstancetype

metadata:

name: example-instancetype

spec:

cpu:

guest: 1 1

memory:

guest: 128Mi 2

您可以使用 virtctl CLI 实用程序创建实例类型清单。例如:

带有必填字段的 virtctl 命令示例

$ virtctl create instancetype --cpu 2 --memory 256Mi

其中:

--cpu <value>- 指定要分配给客户机的 vCPU 数量。必需。

--memory <value>- 指定要分配给客户机的内存量。必需。

您可以运行以下命令来立即从新清单中创建对象:

$ virtctl create instancetype --cpu 2 --memory 256Mi | oc apply -f -

7.1.2.1.2. 可选属性

除了所需的 cpu 和 memory 属性外,您还可以在 VirtualMachineInstancetypeSpec 中包含以下可选属性:

annotations- 列出应用到虚拟机的注解。

gpus- 列出用于 passthrough 的 vGPU。

hostDevices- 列出用于透传的主机设备。

ioThreadsPolicy- 定义用于管理专用磁盘访问的 IO 线程策略。

launchSecurity- 配置安全加密虚拟化 (SEV)。

nodeSelector- 指定节点选择器来控制调度此虚拟机的节点。

schedulerName- 定义用于此虚拟机的自定义调度程序,而不是默认的调度程序。

7.1.2.2. 预定义的实例类型

OpenShift Virtualization 包括一组预定义的实例类型,称为 common-instancetypes。一些会针对特定工作负载进行定制,另一些则与工作负载无关。

这些实例类型资源根据其系列、版本和大小命名。大小值使用 . 分隔符,范围从 nano 到 8xlarge。

| 使用案例 | 系列 | 特性 | vCPU 与内存的比率 | 资源示例 |

|---|---|---|---|---|

| Universal | U |

| 1:4 |

|

| 过量使用 | O |

| 1:4 |

|

| compute-exclusive | CX |

| 1:2 |

|

| NVIDIA GPU | GN |

| 1:4 |

|

| 内存密集型 | M |

| 1:8 |

|

| Network-intensive | N |

| 1:2 |

|

7.1.2.3. 使用 virtctl 工具创建清单

您可使用 virtctl CLI 实用程序简化为虚拟机、虚拟机实例类型和虚拟机首选项创建清单。如需更多信息,请参阅虚拟机清单创建命令。

如果您有 VirtualMachine 清单,可以从命令行创建虚拟机。

7.1.2.4. 使用 Web 控制台从实例类型创建虚拟机

您可以使用 OpenShift Container Platform web 控制台从实例类型创建虚拟机 (VM)。您还可以通过复制现有快照或克隆虚拟机,来使用 Web 控制台创建虚拟机。

您可以从可用可引导卷列表创建虚拟机。您可以在列表中添加基于 Linux 或 Windows 的卷。

流程

在 Web 控制台中,进入到 Virtualization → Catalog。

InstanceTypes 选项卡默认为打开。

选择以下选项之一:

从列表中选择合适的可引导卷。如果列表已被截断,请点 Show all 按钮来显示整个列表。

注意可引导的卷表仅列出

openshift-virtualization-os-images命名空间中具有instancetype.kubevirt.io/default-preference标签的卷。- 可选:点星号图标将可引导卷指定为热门卷。不足的可引导卷首先出现在卷列表中。

点 Add volume 上传新卷,或使用现有的持久性卷声明(PVC)、卷快照或

containerDisk卷。点击 Save。集群中不可用的操作系统的徽标显示在列表的底部。您可以点 Add volume 链接为所需的操作系统添加卷。

另外,还有 创建 Windows 引导源快速启动的链接。如果您将鼠标悬停在 Select volume to boot from 行旁边的问号图标上,则同一链接会出现在弹出窗口中。

安装环境或环境断开连接后,从中引导的卷列表为空。在这种情况下,会显示三个操作系统徽标:Windows、RHEL 和 Linux。您可以点 Add volume 按钮添加新卷来满足您的要求。

- 点实例类型标题,然后选择适合您的工作负载的资源大小。

可选:选择虚拟机详情,包括虚拟机的名称,适用于您要从其引导的卷:

对于基于 Linux 的卷,请按照以下步骤配置 SSH:

- 如果您还没有在项目中添加公共 SSH 密钥,点 VirtualMachine details 部分中的 Authorized SSH key 旁边的编辑图标。

选择以下选项之一:

- 使用现有 :从 secrets 列表中选择一个 secret。

Add new: 遵循以下步骤:

- 浏览到公共 SSH 密钥文件,或在 key 字段中粘贴文件。

- 输入 secret 名称。

- 可选: 选择 Automatically apply this key to any new VirtualMachine you create in this project。

- 点击 Save。

对于 Windows 卷,请按照以下步骤配置 sysprep 选项:

如果您还没有为 Windows 卷添加 sysprep 选项,请按照以下步骤执行:

- 点 VirtualMachine 详情 部分中的 Sysprep 的编辑图标。

- 添加 Autoattend.xml 回答文件。

- 添加 Unattend.xml 回答文件。

- 点击 Save。

如果要将现有的 sysprep 选项用于 Windows 卷,请按照以下步骤执行:

- 点 Attach existing sysprep。

- 输入现有 sysprep Unattend.xml 回答文件的名称。

- 点击 Save。

可选: 如果要创建 Windows 虚拟机,您可以挂载 Windows 驱动程序磁盘:

- 点 Customize VirtualMachine 按钮。

- 在 VirtualMachine 详情页中,点 Storage。

- 选择 Mount Windows 驱动程序磁盘复选框。

- 可选:点 View YAML & CLI 查看 YAML 文件。点 CLI 查看 CLI 命令。您还可以下载或复制 YAML 文件内容或 CLI 命令。

- 点 Create VirtualMachine。

创建虚拟机后,您可以在 VirtualMachine 详情页中监控状态。

7.1.3. 从模板创建虚拟机

您可以使用 OpenShift Container Platform web 控制台从红帽模板创建虚拟机 (VM)。

7.1.3.1. 关于虚拟机模板

- 引导源

您可以使用有可用引导源的模板加快虚拟机创建。如果带有引导源的模板没有自定义标签,则会被标记为 Available boot source。

没有引导源的模板被标记为 Boot source required。请参阅从自定义镜像创建虚拟机。

- 自定义

- 在启动虚拟机前,您可以自定义磁盘源和虚拟机参数。

如果您使用所有标签和注解复制虚拟机模板,则当部署新版本的 Scheduling、Scale 和 Performance (SSP) Operator 时,您的模板版本将被标记为已弃用。您可以删除此设计。请参阅使用 Web 控制台自定义虚拟机模板。

- 单节点 OpenShift

-

由于存储行为的区别,一些模板与单节点 OpenShift 不兼容。为确保兼容性,请不要为使用数据卷或存储配置集的模板或虚拟机设置

evictionStrategy字段。

7.1.3.2. 从模板创建虚拟机

您可以使用 OpenShift Container Platform web 控制台从带有可用引导源的模板创建虚拟机 (VM)。

可选: 在启动虚拟机前,您可以自定义模板或虚拟机参数,如数据源、cloud-init 或 SSH 密钥。

流程

- 在 web 控制台中进入到 Virtualization → Catalog。

点 Boot source available 来使用引导源过滤模板。

目录显示默认模板。点 All Items 查看您的过滤器的所有可用模板。

- 点模板标题查看其详情。

- 可选:如果您使用 Windows 模板,可以通过选择 Mount Windows 驱动程序磁盘复选框来挂载 Windows 驱动程序磁盘。

如果您不需要自定义模板或虚拟机参数,点 Quick create VirtualMachine 从模板创建虚拟机。

如果您需要自定义模板或虚拟机参数,请执行以下操作:

- 点 Customize VirtualMachine。

- 展开 Storage 或 Optional 参数,以编辑数据源设置。

点 Customize VirtualMachine 参数。

Customize and create VirtualMachine 窗格显示 Overview, YAML, Scheduling, Environment, Network interfaces, Disks, Scripts, 和 Metadata 标签页。

- 编辑在虚拟机引导前必须设置的参数,如 cloud-init 或静态 SSH 密钥。

点 Create VirtualMachine。

VirtualMachine 详情页面会显示 provisioning 状态。

7.1.3.2.1. 存储卷类型

| Type | 描述 |

|---|---|

| ephemeral | 将网络卷用作只读后备存储的本地写时复制 (COW) 镜像。后备卷必须为 PersistentVolumeClaim。当虚拟机启动并在本地存储所有写入数据时,便会创建临时镜像。当虚拟机停止、重启或删除时,便会丢弃临时镜像。其底层的卷 (PVC) 不会以任何方式发生变化。 |

| persistentVolumeClaim | 将可用 PV 附加到虚拟机。附加 PV 可确保虚拟机数据在会话之间保持。 将现有虚拟机导入到 OpenShift Container Platform 中的建议方法是,使用 CDI 将现有虚拟机磁盘导入到 PVC 中,然后将 PVC 附加到虚拟机实例。在 PVC 中使用磁盘需要满足一些要求。 |

| dataVolume |

通过导入、克隆或上传操作来管理虚拟机磁盘的准备过程,以此在

指定 |

| cloudInitNoCloud | 附加包含所引用的 cloud-init NoCloud 数据源的磁盘,从而向虚拟机提供用户数据和元数据。虚拟机磁盘内部需要安装 cloud-init。 |

| containerDisk | 引用容器镜像 registry 中存储的镜像,如虚拟机磁盘。镜像从 registry 中拉取,并在虚拟机启动时作为磁盘附加到虚拟机。

容器镜像 registry 仅支持 RAW 和 QCOW2 格式的磁盘类型。建议使用 QCOW2 格式以减小镜像的大小。 注意

|