16.4. 사용자 프로비저닝 인프라를 사용하여 RHV에 클러스터 설치

OpenShift Container Platform 버전 4.9에서는 RHV(Red Hat Virtualization) 및 사용자가 제공하는 기타 인프라에 사용자 지정 OpenShift Container Platform 클러스터를 설치할 수 있습니다. OpenShift Container Platform 문서에서는 사용자 프로비저닝 인프라라는 용어를 사용하여 이러한 인프라 유형을 나타냅니다.

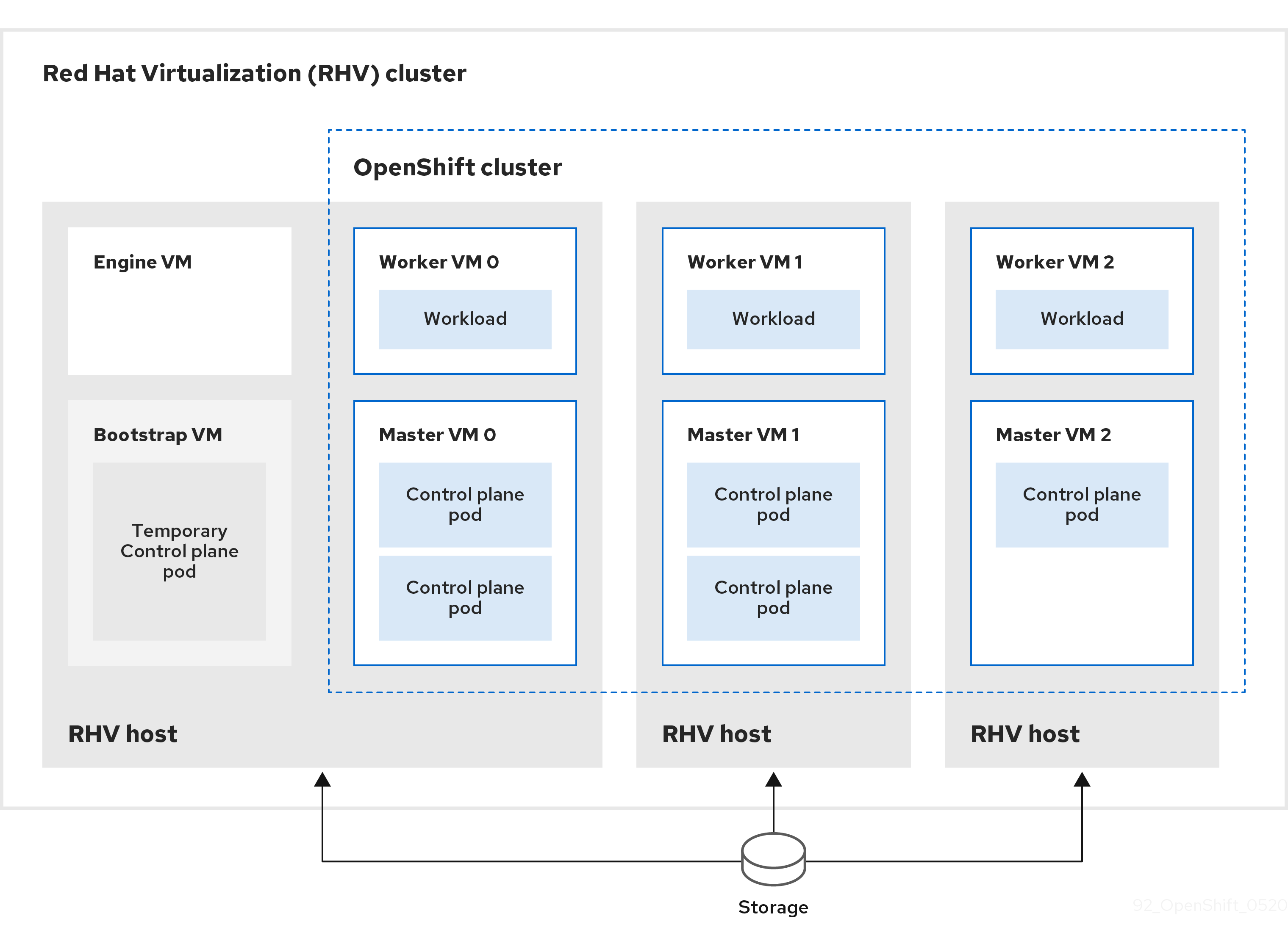

다음 다이어그램은 RHV 클러스터에서 실행되는 잠재적인 OpenShift Container Platform 클러스터의 예를 보여줍니다.

RHV 호스트는 컨트롤 플레인과 컴퓨팅 pod를 모두 포함하는 가상 머신을 실행합니다. 또한 호스트 중 하나는 관리자 가상 머신과 임시 컨트롤 플레인 pod가 포함된 부트스트랩 가상 머신을 실행합니다.]

16.4.1. 사전 요구 사항

RHV 환경에 OpenShift Container Platform 클러스터를 설치하려면 다음 요구사항을 충족해야 합니다.

- OpenShift Container Platform 설치 및 업데이트 프로세스에 대한 세부 사항을 검토합니다.

- 클러스터 설치 방법 선택 및 사용자를 위한 준비에 대한 문서를 읽습니다.

- RHV(Red Hat Virtualization)의 OpenShift Container Platform 지원 매트릭스에서 지원되는 버전 조합이 있습니다.

16.4.2. OpenShift Container Platform 용 인터넷 액세스

OpenShift Container Platform 4.9에서 클러스터를 설치하려면 인터넷 액세스가 필요합니다.

다음의 경우 인터넷 액세스가 필요합니다.

- OpenShift Cluster Manager 에 액세스하여 설치 프로그램을 다운로드하고 서브스크립션 관리를 수행합니다. 클러스터가 인터넷에 액세스할 수 있고 Telemetry 서비스를 비활성화하지 않은 경우, 클러스터에 자동으로 권한이 부여됩니다.

- Quay.io에 액세스. 클러스터를 설치하는 데 필요한 패키지를 받을 수 있습니다.

- 클러스터 업데이트를 수행하는 데 필요한 패키지를 받을 수 있습니다.

클러스터가 직접 인터넷에 액세스할 수 없는 경우, 프로비저닝하는 일부 유형의 인프라에서 제한된 네트워크 설치를 수행할 수 있습니다. 이 프로세스 동안 필요한 콘텐츠를 다운로드하고 이를 사용하여 설치 패키지로 미러 레지스트리를 채웁니다. 설치 유형에 따라서는 클러스터를 설치하는 환경에 인터넷 액세스가 필요하지 않을 수도 있습니다. 클러스터를 업데이트하기 전에 미러 레지스트리의 내용을 업데이트합니다.

16.4.3. RHV 환경 요구사항

OpenShift Container Platform 버전 4.9 클러스터를 설치하고 실행하려면 RHV 환경이 다음 요구 사항을 충족해야 합니다.

이러한 요구 사항을 충족하지 않으면 설치 또는 프로세스가 실패할 수 있습니다. 또한 이러한 요구 사항을 충족하지 않으면 OpenShift Container Platform 클러스터가 설치 후 며칠 또는 몇 주에 실패할 수 있습니다.

CPU, 메모리, 스토리지에 대한 다음 요구사항은 설치 프로그램이 생성하는 기본 가상 시스템 수를 곱한 기본 값을 기반으로 합니다. 이러한 리소스는 RHV 환경에서 비 OpenShift Container Platform 작업에 사용하는 리소스와함께 사용할 수 있어야 합니다.

설치 프로그램은 기본적으로 설치 프로세스 중에 일곱 개의 가상 시스템을 생성합니다. 먼저 나머지 OpenShift Container Platform 클러스터를 생성하는 동안 임시 서비스와 컨트롤 플레인 영역을 제공하는 부트스트랩 가상 머신을 생성합니다. 설치 프로그램이 클러스터 생성을 완료하면 부트스트랩 시스템을 삭제하여 리소스를 확보합니다.

RHV 환경에서 가상 머신 수를 늘리면 그에 따라 리소스를 늘려야합니다.

요구사항

- RHV 버전은 4.4입니다.

- RHV 환경에는 상태가 Up인 데이터 센터가 하나 있습니다.

- RHV 데이터 센터에는 RHV 클러스터가 포함되어 있습니다.

RHV 클러스터에는 다음과 같은 OpenShift Container Platform 클러스터 전용 리소스가 있습니다.

- 최소 28개의 vCPU(설치 중 생성된 일곱 개의 가상 시스템마다 각각 4개)

다음을 포함한 112GiB RAM 이상

- 임시 컨트롤 플레인을 제공하는 부트스트랩 시스템의 경우 16GiB 이상

- 컨트롤 플레인을 제공하는 컨트롤 플레인 시스템 세 개 각각에 대해 16GiB 이상

- 애플리케이션 워크로드를 실행하는 컴퓨팅 시스템 세 개 각각에 대해 16GiB 이상

- RHV 스토리지 도메인은 이러한 etcd 백엔드 성능 요구사항을 충족해야 합니다.

- 프로덕션 환경에서 각 가상 머신은 120GiB 이상이어야 합니다. 따라서 스토리지 도메인은 기본 OpenShift Container Platform 클러스터에 대해 840GiB 이상을 제공해야 합니다. 리소스가 제한적인 환경이나 프로덕션 이외의 환경에서는 각 가상 시스템에 32GiB 이상이 있어야 하므로 스토리지 도메인에는 기본 OpenShift Container Platform 클러스터에 필요한 230GiB 이상이 있어야 합니다.

- 설치 및 업데이트 중에 Red Hat Ecosystem Catalog에서 이미지를 다운로드하려면 RHV 클러스터가 인터넷 연결에 액세스할 수 있어야 합니다. Telemetry 서비스에는 서브스크립션 및 권한 부여 프로세스를 단순화하기 위해 인터넷 연결이 필요합니다.

- RHV 클러스터에는 RHV Manager의 REST API에 액세스할 수 있는 가상 네트워크가 있어야 합니다. 설치 관리자가 생성한 VM에서 DHCP를 사용하여 IP 주소를 얻을 수 있으므로 이 네트워크에서 DHCP가 활성화되어 있는지 확인합니다.

대상 RHV 클러스터에서 OpenShift Container Platform 클러스터를 설치 및 관리하기 위한 다음과 같은 최소 권한이있는 사용자 계정 및 그룹:

-

DiskOperator -

DiskCreator -

UserTemplateBasedVm -

TemplateOwner -

TemplateCreator -

대상 클러스터의

ClusterAdmin

-

최소 권한 원칙을 적용합니다. 설치 과정에서 RHV에 대한 SuperUser 권한이 있는 관리자 계정을 사용하지 않도록 합니다. 설치 프로그램은 사용자가 제공한 인증 정보를 손상된 임시 ovirt-config.yaml 파일에 저장합니다.

16.4.4. RHV 환경에 대한 요구사항 확인

RHV 환경이 OpenShift Container Platform 클러스터 설치 및 실행 요구사항을 충족하는지 확인합니다. 이러한 요구사항을 충족하지 않으면 실패할 수 있습니다.

이러한 요구사항은 설치 프로그램이 컨트롤 플레인과 컴퓨팅 시스템을 생성하는 데 사용하는 기본 리소스를 기반으로 합니다. 이러한 리소스에는 vCPU, 메모리 및 스토리지가 포함됩니다. 이러한 리소스를 변경하거나 OpenShift Container Platform 시스템 수를 늘리는 경우에는 그에 따라 이 요구사항을 조정합니다.

절차

RHV 버전이 OpenShift Container Platform 버전 4.9의 설치를 지원하는지 확인합니다.

- RHV 관리 포털에서 오른쪽 상단에 있는 ? 도움말 아이콘을 클릭하고 정보를 선택합니다.

- 창이 열리면 RHV 소프트웨어 버전을 기록합니다.

- RHV 버전이 4.4인지 확인합니다. 지원되는 버전 조합에 대한 자세한 내용은 RHV의 OpenShift Container Platform에 대한 지원 매트릭스를 참조하십시오.

데이터 센터, 클러스터 및 스토리지를 검사합니다.

-

RHV 관리 포털에서 Compute

Data Centers를 클릭합니다. - OpenShift Container Platform을 설치하려는 데이터 센터에 액세스할 수 있는지 확인합니다.

- 해당 데이터 센터의 이름을 클릭합니다.

- 데이터 센터 세부 사항의 스토리지 탭에서 OpenShift Container Platform을 설치하려는 스토리지 도메인이 활성인지 확인합니다.

- 나중에 사용할 수 있도록 도메인 이름을 기록합니다.

- 여유 공간이 230GiB 이상인지 확인합니다.

- 스토리지 도메인이 fio 성능 벤치마킹 툴을 사용하여 측정할 수 있는 이러한 etcd 백엔드 성능 요구사항을 충족하는지 확인합니다.

- 데이터 센터 세부 사항에서 클러스터 탭을 클릭합니다.

- OpenShift Container Platform을 설치할 RHV 클러스터를 찾습니다. 나중에 사용할 수 있도록 클러스터 이름을 기록합니다.

-

RHV 관리 포털에서 Compute

RHV 호스트 리소스를 검사합니다.

- RHV 관리 포털에서 컴퓨팅 > 클러스터를 클릭합니다.

- OpenShift Container Platform을 설치할 클러스터를 클릭합니다.

- 클러스터 세부 사항에서 호스트 탭을 클릭합니다.

- 호스트를 검사하고 OpenShift Container Platform 클러스터 전용으로 사용할 수 있는 총 28개 이상의 논리 CPU 코어가 있는지 확인합니다.

- 나중에 사용할 수 있도록 사용 가능한 논리 CPU 코어 수를 기록합니다.

- 설치 중에 생성된 7개의 가상 시스템 각각에 4개의 코어가 있을 수 있도록 이러한 CPU 코어가 분산되어 있는지 확인합니다.

다음 OpenShift Container Platform 시스템 각각에 대한 요구사항을 충족하기 위해 배포된 새 가상 시스템 예약에 필요한 112GiB의 최대 여유 메모리가 모두 호스트에 있는지 확인합니다.

- 부트스트랩 시스템에 필요한 16GiB

- 세 개의 컨트롤 플레인 시스템 각각에 필요한 16GiB

- 세 개의 컴퓨팅 시스템 각각에 대해 16GiB

- 나중에 사용할 수 있도록 새 가상 시스템 예약에 필요한 최대 여유 메모리의 양을 기록합니다.

OpenShift Container Platform을 설치할 가상 네트워크가 RHV Manager의 REST API에 액세스할 수 있는지 확인합니다. 이 네트워크의 가상 시스템에서 RHV 관리자의 REST API에 도달하기 위해 curl을 사용합니다.

$ curl -k -u <username>@<profile>:<password> \1 https://<engine-fqdn>/ovirt-engine/api2 예를 들면 다음과 같습니다.

$ curl -k -u ocpadmin@internal:pw123 \ https://rhv-env.virtlab.example.com/ovirt-engine/api

16.4.5. 사용자 프로비저닝 인프라에 대한 네트워킹 요구사항

모든 RHCOS(Red Hat Enterprise Linux CoreOS) 시스템이 부팅 중에 Ignition 구성 파일을 가져오려면 initramfs에 네트워킹을 구성해야 합니다.

초기 부팅 과정에서 시스템에 필요한 부팅 옵션을 제공하여 DHCP 서버를 통해 설정하거나 정적으로 설정하는 IP 주소 구성이 필요합니다. 네트워크 연결이 설정된 후 시스템은 HTTP 또는 HTTPS 서버에서 Ignition 구성 파일을 다운로드합니다. 그런 다음 Ignition 구성 파일을 사용하여 각 머신의 정확한 상태를 설정합니다. Machine Config Operator는 설치 후 새 인증서 또는 키 적용과 같은 머신에 대한 추가 변경을 완료합니다.

클러스터 시스템의 장기적인 관리를 위해 DHCP 서버를 사용하는 것이 좋습니다. DHCP 서버가 클러스터 시스템에 영구 IP 주소, DNS 서버 정보 및 호스트 이름을 제공하도록 구성되었는지 확인합니다.

사용자 프로비저닝 인프라에 DHCP 서비스를 사용할 수 없는 경우 RHCOS 설치 시 노드에 IP 네트워킹 구성과 DNS 서버의 주소를 대신 제공할 수 있습니다. ISO 이미지에서 설치하는 경우 부팅 인수로 전달할 수 있습니다. 고정 IP 프로비저닝 및 고급 네트워킹 옵션에 대한 자세한 내용은 RHCOS 설치 및 OpenShift Container Platform 부트스트랩 프로세스 시작 섹션을 참조하십시오.

Kubernetes API 서버가 클러스터 시스템의 노드 이름을 확인할 수 있어야 합니다. API 서버와 작업자 노드가 서로 다른 영역에 있는 경우, API 서버가 노드 이름을 확인할 수 있도록 기본 DNS 검색 영역을 설정할 수 있습니다. 노드 개체와 모든 DNS 요청에서 항상 정규화된 도메인 이름으로 호스트를 가리키는 것도 지원되는 방법입니다

방화벽

클러스터가 필수 사이트에 액세스할 수 있도록 방화벽을 구성하십시오.

또한 다음을 참조하십시오.

로드 밸런서

하나 또는 두 개의 계층-4 로드 밸런서를 구성합니다.

-

컨트롤 플레인 및 부트스트랩 머신에서 포트

6443및22623에 대한 로드 밸런싱을 제공합니다. 포트6443은 Kubernetes API 서버에 대한 액세스를 제공하며 내부 및 외부 모두에 연결할 수 있어야합니다. 포트22623은 클러스터 내부 노드에서 액세스할 수 있어야 합니다. -

일반적으로 기본 구성의 계산 노드인 Ingress 라우터를 실행하는 시스템에 포트

443및80의 로드 밸런싱을 제공합니다. 두 포트 모두 클러스터 내부와 외부에서 액세스할 수 있어야합니다.

DNS

기본 구성 요소 및 서비스를 올바르게 확인할 수 있도록 인프라 제공 DNS를 구성합니다. 로드 밸런서를 하나만 사용하는 경우 이러한 DNS 레코드는 동일한 IP 주소를 가리킬 수 있습니다.

-

컨트롤 플레인 시스템의 로드 밸런서를 가리키는

api.<cluster_name>.<base_domain>(internal and external resolution) 및api-int.<cluster_name>.<base_domain>(internal resolution)에 대한 DNS 레코드를 생성합니다. -

Ingress 라우터의 로드 밸런서를 가리키는

*.apps.<cluster_name>.<base_domain>의 DNS 레코드를 생성합니다. 예를 들어 컴퓨팅 머신의 포트443및80입니다.

16.4.5.1. DHCP를 통해 클러스터 노드의 호스트 이름 설정

RHCOS(Red Hat Enterprise Linux CoreOS) 시스템에서 호스트 이름은 NetworkManager를 통해 설정됩니다. 기본적으로 시스템은 DHCP를 통해 호스트 이름을 가져옵니다. DHCP에서 호스트 이름을 제공하지 않거나, 커널 인수를 통해 정적으로 설정하거나 다른 방법을 통해 설정하면 역방향 DNS 조회를 통해 얻을 수 있습니다. 역방향 DNS 조회는 노드에서 네트워크를 초기화한 후 수행되며 확인하는 데 시간이 걸릴 수 있습니다. 다른 시스템 서비스는 이 보다 먼저 시작하여 호스트 이름을 localhost 등으로 감지할 수 있습니다. DHCP를 사용하여 각 클러스터 노드의 호스트 이름을 제공하여 이 문제를 방지할 수 있습니다.

또한 DHCP를 통해 호스트 이름을 설정하면 DNS 분할 수평 구현 환경에서 수동으로 DNS 레코드 이름 구성 오류를 무시할 수 있습니다.

16.4.5.2. 네트워크 연결 요구사항

OpenShift Container Platform 클러스터 구성 요소가 통신할 수 있도록 시스템 간 네트워크 연결을 구성해야 합니다. 각 시스템에서 클러스터에 있는 다른 모든 시스템의 호스트 이름을 확인할 수 있어야 합니다.

이 섹션에서는 필요한 포트에 대해 자세히 설명합니다.

연결된 OpenShift Container Platform 환경에서 모든 노드는 플랫폼 컨테이너의 이미지를 가져오고 Red Hat에 원격 측정 데이터를 제공하기 위해 인터넷에 액세스할 수 있어야 합니다.

| 프로토콜 | 포트 | 설명 |

|---|---|---|

| ICMP | 해당 없음 | 네트워크 연결성 테스트 |

| TCP |

| 메트릭 |

|

|

| |

|

| Kubernetes에서 예약하는 기본 포트 | |

|

| openshift-sdn | |

| UDP |

| VXLAN 및 Geneve |

|

| VXLAN 및 Geneve | |

|

|

| |

|

| IPsec IKE 패킷 | |

|

| IPsec NAT-T 패킷 | |

| TCP/UDP |

| Kubernetes 노드 포트 |

| ESP | 해당 없음 | IPsec Encapsulating Security Payload (ESP) |

| 프로토콜 | 포트 | 설명 |

|---|---|---|

| TCP |

| Kubernetes API |

| 프로토콜 | 포트 | 설명 |

|---|---|---|

| TCP |

| etcd 서버 및 피어 포트 |

사용자 프로비저닝 인프라에 대한 NTP 구성

OpenShift Container Platform 클러스터는 기본적으로 공용 NTP(Network Time Protocol) 서버를 사용하도록 구성되어 있습니다. 로컬 엔터프라이즈 NTP 서버를 사용하거나 클러스터가 연결이 끊긴 네트워크에 배포되는 경우 특정 시간 서버를 사용하도록 클러스터를 구성할 수 있습니다. 자세한 내용은 chrony 타임 서비스 설정 문서를 참조하십시오.

DHCP 서버가 NTP 서버 정보를 제공하는 경우 RHCOS(Red Hat Enterprise Linux CoreOS) 시스템의 chrony 타임 서비스에서 정보를 읽고 NTP 서버와 클럭을 동기화할 수 있습니다.

16.4.6. 설치 시스템 설정

바이너리 openshift-install 설치 프로그램 및 Ansible 스크립트를 실행하려면 RHV Manager 또는 RHV 환경에 대한 네트워크 액세스 권한이 있는 RHEL(Red Hat Enterprise Linux) 컴퓨터와 Manager에서 REST API를 설정합니다.

절차

Python3 및 Ansible을 업데이트하거나 설치합니다. 예를 들면 다음과 같습니다.

# dnf update python3 ansible-

python3-ovirt-engine-sdk4패키지를 설치하여 Python 소프트웨어 개발 키트를 가져옵니다. ovirt.image-templateAnsible 역할을 설치합니다. RHV Manager 및 기타 RHEL(Red Hat Enterprise Linux) 시스템에서 이 역할은ovirt-ansible-image-template패키지로 배포됩니다. 예를 들면 다음과 같습니다.# dnf install ovirt-ansible-image-templateovirt.vm-infraAnsible 역할을 설치합니다. RHV Manager 및 기타 RHEL 시스템에서 이 역할은ovirt-ansible-vm-infra패키지로 배포됩니다.# dnf install ovirt-ansible-vm-infra환경 변수를 만들고 절대 또는 상대 경로를 할당합니다. 예를 들면 다음과 같습니다.

$ export ASSETS_DIR=./wrk참고설치 프로그램은 이 변수를 사용하여 중요한 설치 관련 파일을 저장하는 디렉터리를 만듭니다. 나중에 설치 프로세스는 이 변수를 사용하여 해당 자산 파일을 찾습니다. 이 assets 디렉터리를 삭제하지 마십시오. 이는 클러스터를 제거하는 데 필요합니다.

16.4.7. 비보안 모드에서 RHV에 OpenShift Container Platform 설치

기본적으로 설치 관리자는 CA 인증서를 생성하고 확인을 요청한 후 설치 중에 사용할 인증서를 저장합니다. 수동으로 생성하거나 설치할 필요가 없습니다.

권장되지는 않지만 비보안 모드로 OpenShift Container Platform을 설치하여 인증서를 확인하지 않고도 이 기능을 재정의하고 OpenShift Container Platform을 설치할 수 있습니다.

잠재적인 공격자가 중Man-in-the-Middle 공격을 수행할 수 있고 네트워크에서 중요한 인증 정보를 캡처할 수 있으므로 비보안 모드에 설치하는 것은 권장되지 않습니다.

절차

-

~/.ovirt/ovirt-config.yaml이라는 파일을 생성합니다. ovirt-config.yaml에 다음 내용을 추가합니다.ovirt_url: https://ovirt.example.com/ovirt-engine/api1 ovirt_fqdn: ovirt.example.com2 ovirt_pem_url: "" ovirt_username: ocpadmin@internal ovirt_password: super-secret-password3 ovirt_insecure: true- 설치 프로그램을 실행합니다.

16.4.8. 클러스터 노드 SSH 액세스를 위한 키 쌍 생성

OpenShift Container Platform을 설치하는 동안 SSH 공개 키를 설치 프로그램에 지정할 수 있습니다. 키는 Ignition 구성 파일을 통해 RHCOS(Red Hat Enterprise Linux CoreOS) 노드에 전달되며 노드에 대한 SSH 액세스를 인증하는 데 사용됩니다. 키는 각 노드에서 core 사용자의 ~/.ssh/authorized_keys 목록에 추가되어 암호 없는 인증을 활성화합니다.

키가 노드에 전달되면 키 쌍을 사용하여 사용자 core로 RHCOS 노드에 SSH로 SSH 연결을 수행할 수 있습니다 . SSH를 통해 노드에 액세스하려면 로컬 사용자의 SSH에서 개인 키 ID를 관리해야 합니다.

설치 디버깅 또는 재해 복구를 수행하기 위해 클러스터 노드에 SSH를 실행하려면 설치 프로세스 중에 SSH 공용 키를 지정해야 합니다. ./openshift-install gather 명령에도 SSH 공개 키가 클러스터 노드에 있어야 합니다.

재해 복구 및 디버깅이 필요한 프로덕션 환경에서는이 단계를 생략하지 마십시오.

AWS 키 쌍과 같이 플랫폼 고유의 방식으로 구성된 키가 아닌 로컬 키를 사용해야 합니다.

절차

로컬 시스템에 클러스터 노드의 인증에 사용할 기존 SSH 키 쌍이 없는 경우 새로 생성합니다. 예를 들어 Linux 운영 체제를 사용하는 컴퓨터에서 다음 명령을 실행합니다.

$ ssh-keygen -t ed25519 -N '' -f <path>/<file_name>1 - 1

- 새 SSH 키의 경로 및 파일 이름(예:

~/.ssh/id_ed25519)을 지정합니다. 기존 키 쌍이 있는 경우 공개 키가'~/.ssh디렉터리에 있는지 확인하십시오.

참고x86_64아키텍처에 FIPS 검증 / 진행중인 모듈 (Modules in Process) 암호화 라이브러리를 사용하는 OpenShift Container Platform 클러스터를 설치하려면ed25519알고리즘을 사용하는 키를 생성하지 마십시오. 대신rsa또는ecdsa알고리즘을 사용하는 키를 생성합니다.공개 SSH 키를 확인합니다.

$ cat <path>/<file_name>.pub예를 들어 다음을 실행하여

~/.ssh/id_ed25519.pub공개 키를 확인합니다.$ cat ~/.ssh/id_ed25519.pub아직 추가되지 않은 경우 로컬 사용자의 SSH 에이전트에 SSH 개인 키 ID를 추가합니다. 키의 SSH 에이전트 관리는 클러스터 노드에 암호 없는 SSH 인증을 수행하거나

./openshift-install gather명령을 사용하려는 경우 필요합니다.참고일부 배포에서는

~/.ssh/id_rsa및~/.ssh/id_dsa와 같은 기본 SSH 개인 키 ID가 자동으로 관리됩니다.ssh-agent프로세스가 로컬 사용자에 대해 실행되지 않은 경우 백그라운드 작업으로 시작합니다.$ eval "$(ssh-agent -s)"출력 예

Agent pid 31874참고클러스터가 FIPS 모드인 경우 FIPS 호환 알고리즘만 사용하여 SSH 키를 생성합니다. 키는 RSA 또는 ECDSA여야 합니다.

ssh-agent에 SSH 개인 키를 추가합니다.$ ssh-add <path>/<file_name>1 - 1

- SSH 개인 키의 경로 및 파일 이름을 지정합니다(예:

~/.ssh/id_ed25519).

출력 예

Identity added: /home/<you>/<path>/<file_name> (<computer_name>)

다음 단계

- OpenShift Container Platform을 설치할 때 SSH 공개 키를 설치 프로그램에 지정합니다.

16.4.9. 설치 프로그램 받기

OpenShift Container Platform을 설치하기 전에 로컬 컴퓨터에 설치 파일을 다운로드합니다.

사전 요구 사항

- 500MB의 로컬 디스크 공간이 있는 Linux 또는 macOS를 실행하는 컴퓨터가 있습니다.

절차

- OpenShift Cluster Manager 사이트의 인프라 공급자 페이지에 액세스합니다. Red Hat 계정이 있으면 사용자 자격 증명으로 로그인합니다. 계정이 없으면 계정을 만드십시오.

- 인프라 공급자를 선택합니다.

설치 유형 페이지로 이동한 다음, 운영 체제에 맞는 설치 프로그램을 다운로드하여 설치 구성 파일을 저장할 디렉터리에 파일을 저장합니다.

중요설치 프로그램은 클러스터를 설치하는 데 사용하는 컴퓨터에 여러 파일을 만듭니다. 클러스터 설치를 마친 후 설치 프로그램과 설치 프로그램으로 생성되는 파일을 보관해야 합니다. 클러스터를 삭제하려면 두 파일이 모두 필요합니다.

중요클러스터 설치에 실패하거나 설치 프로그램으로 만든 파일을 삭제해도 클러스터는 제거되지 않습니다. 클러스터를 제거하려면 해당 클라우드 공급자에 적용되는 OpenShift Container Platform 설치 제거 절차를 완료해야 합니다.

설치 프로그램 파일의 압축을 풉니다. 예를 들어 Linux 운영 체제를 사용하는 컴퓨터에서 다음 명령을 실행합니다.

$ tar -xvf openshift-install-linux.tar.gz- Red Hat OpenShift Cluster Manager에서 설치 풀 시크릿 을 다운로드합니다. 이 풀 시크릿을 사용하면 OpenShift Container Platform 구성 요소에 대한 컨테이너 이미지를 제공하는 Quay.io를 포함하여 인증 기관에서 제공하는 서비스로 인증할 수 있습니다.

16.4.10. Ansible Playbook 다운로드

RHV에 OpenShift Container Platform 4.9 버전을 설치하기 위한 Ansible 플레이북을 다운로드합니다.

절차

설치 시스템에서 다음 명령을 실행하십시오.

$ mkdir playbooks$ cd playbooks$ curl -s -L -X GET https://api.github.com/repos/openshift/installer/contents/upi/ovirt?ref=release-4.9 | grep 'download_url.*\.yml' | awk '{ print $2 }' | sed -r 's/("|",)//g' | xargs -n 1 curl -O

다음 단계

-

이러한 Ansible Playbook을 다운로드한 후 설치 프로그램을 실행하여 설치 구성 파일을 생성하기 전에 assets 디렉터리에 대한 환경 변수를 생성하고

inventory.yml파일을 사용자 정의해야 합니다.

16.4.11. inventory.yml 파일

inventory.yml 파일을 사용하여 설치하려는 OpenShift Container Platform 클러스터의 요소를 정의하고 생성합니다. 여기에는 RHCOS (Red Hat Enterprise Linux CoreOS) 이미지, 가상 머신 템플릿, 부트스트랩 머신, 컨트롤 플레인 노드 및 작업자 노드와 같은 요소가 포함됩니다. 또한 inventory.yml을 사용하여 클러스터를 제거합니다.

다음 inventory.yml예에서는 매개 변수와 매개 변수 기본값을 보여줍니다. 이러한 기본값의 수량과 숫자는 RHV 환경에서 프로덕션 OpenShift Container Platform 클러스터를 실행하기 위한 요구 사항을 충족합니다.

inventory.yml 파일 예

---

all:

vars:

ovirt_cluster: "Default"

ocp:

assets_dir: "{{ lookup('env', 'ASSETS_DIR') }}"

ovirt_config_path: "{{ lookup('env', 'HOME') }}/.ovirt/ovirt-config.yaml"

# ---

# {op-system} section

# ---

rhcos:

image_url: "https://mirror.openshift.com/pub/openshift-v4/dependencies/rhcos/4.9/latest/rhcos-openstack.x86_64.qcow2.gz"

local_cmp_image_path: "/tmp/rhcos.qcow2.gz"

local_image_path: "/tmp/rhcos.qcow2"

# ---

# Profiles section

# ---

control_plane:

cluster: "{{ ovirt_cluster }}"

memory: 16GiB

sockets: 4

cores: 1

template: rhcos_tpl

operating_system: "rhcos_x64"

type: high_performance

graphical_console:

headless_mode: false

protocol:

- spice

- vnc

disks:

- size: 120GiB

name: os

interface: virtio_scsi

storage_domain: depot_nvme

nics:

- name: nic1

network: lab

profile: lab

compute:

cluster: "{{ ovirt_cluster }}"

memory: 16GiB

sockets: 4

cores: 1

template: worker_rhcos_tpl

operating_system: "rhcos_x64"

type: high_performance

graphical_console:

headless_mode: false

protocol:

- spice

- vnc

disks:

- size: 120GiB

name: os

interface: virtio_scsi

storage_domain: depot_nvme

nics:

- name: nic1

network: lab

profile: lab

# ---

# Virtual machines section

# ---

vms:

- name: "{{ metadata.infraID }}-bootstrap"

ocp_type: bootstrap

profile: "{{ control_plane }}"

type: server

- name: "{{ metadata.infraID }}-master0"

ocp_type: master

profile: "{{ control_plane }}"

- name: "{{ metadata.infraID }}-master1"

ocp_type: master

profile: "{{ control_plane }}"

- name: "{{ metadata.infraID }}-master2"

ocp_type: master

profile: "{{ control_plane }}"

- name: "{{ metadata.infraID }}-worker0"

ocp_type: worker

profile: "{{ compute }}"

- name: "{{ metadata.infraID }}-worker1"

ocp_type: worker

profile: "{{ compute }}"

- name: "{{ metadata.infraID }}-worker2"

ocp_type: worker

profile: "{{ compute }}"매개 변수 설명이 "Enter"로 시작하는 매개 변수의 값을 입력합니다. 그렇지 않으면 기본값을 사용하거나 새 값으로 변경할 수 있습니다.

일반 섹션

-

ovirt_cluster: OpenShift Container Platform 클러스터를 설치할 기존 RHV 클러스터의 이름을 입력합니다. -

ocp.assets_dir:openshift-install설치 프로그램이 생성하는 파일을 저장하기 위해 생성하는 디렉터리의 경로입니다. -

ocp.ovirt_config_path: 설치 프로그램이 생성하는ovirt-config.yaml파일의 경로 (예:./wrk/install-config.yaml)입니다. 이 파일에는 Manager의 REST API와 상호 작용하는 데 필요한 인증 정보가 포함되어 있습니다.

RHCOS(Red Hat Enterprise Linux CoreOS) 섹션

-

image_url: 다운로드를 위해 지정한 RHCOS 이미지의 URL을 입력합니다. -

local_cmp_image_path: 압축된 RHCOS 이미지에 대한 로컬 다운로드 디렉터리의 경로입니다. -

local_image_path: 추출된 RHCOS 이미지에 대한 로컬 디렉터리의 경로입니다.

프로필 섹션

이 섹션은 두 가지 프로필로 구성됩니다.

-

control_plane: 부트스트랩 및 컨트롤 플레인 노드의 프로필입니다. -

compute: 컴퓨팅 플레인에 있는 작업자 노드의 프로필입니다.

이러한 프로필에는 다음과 같은 매개 변수가 있습니다. 매개 변수의 기본값은 프로덕션 클러스터 실행을 위한 최소 요구 사항을 충족합니다. 이러한 값을 증가시키거나 사용자 지정하여 워크로드 요구 사항을 충족할 수 있습니다.

-

cluster: 이 값은 일반 섹션의ovirt_cluster에서 클러스터 이름을 가져옵니다. -

memory: 가상 시스템의 메모리 양(GB)입니다. -

sockets: 가상 시스템의 소켓 수입니다. -

cores: 가상 시스템의 코어 수입니다. -

template: 가상 시스템 템플릿의 이름입니다. 여러 클러스터를 설치할 계획이고 이러한 클러스터가 서로 다른 사양을 포함하는 템플릿을 사용하는 경우 템플릿 이름 앞에 클러스터 ID를 추가합니다. -

operating_system: 가상 시스템의 게스트 운영 체제 유형입니다. oVirt/RHV 버전 4.4에서 이 값은rhcos_x64이어야 하므로Ignition script의 값이 가상 시스템에 전달될 수 있습니다. type: 가상 머신의 유형으로server를 입력합니다.중요type매개 변수의 값을high_performance에서server로 변경해야 합니다.-

disks: 디스크 사양.control_plane및compute노드는 서로 다른 스토리지 도메인을 가질 수 있습니다. -

size: 최소 디스크 크기. -

name: RHV에서 대상 클러스터에 연결된 디스크의 이름을 입력합니다. -

interface: 지정한 디스크의 인터페이스 유형을 입력합니다. -

storage_domain: 지정한 디스크의 스토리지 도메인을 입력합니다. -

nics: 가상 머신이 사용하는name및network를 입력합니다. 가상 네트워크 인터페이스 프로필을 지정할 수도 있습니다. 기본적으로 NIC는 oVirt/RHV MAC 풀에서 MAC 주소를 가져옵니다.

가상 머신 섹션

이 마지막 섹션인 vms는 클러스터에서 생성하고 배포할 가상 시스템을 정의합니다. 기본적으로 프로덕션 환경에 대해 최소한의 컨트롤 플레인 및 작업자 노드를 제공합니다.

vms에는 세 가지 필수 요소가 있습니다.

-

name: 가상 머신의 이름입니다. 이 경우metadata.infraID는 가상 머신 이름 앞에metadata.yml파일의 인프라 ID를 추가합니다. -

ocp_type: OpenShift Container Platform 클러스터에서 가상 머신의 역할입니다. 가능한 값은bootstrap,master,worker입니다. profile: 각 가상 머신이 사양을 상속하는 프로필의 이름입니다. 이 예제에서 가능한 값은control_plane또는compute입니다.가상 머신이 해당 프로필에서 상속하는 값을 재정의할 수 있습니다. 이렇게 하려면

inventory.yml의 가상 머신에 프로필 속성의 이름을 추가하고 재정의 값을 할당합니다. 이 예제를 보려면 이전inventory.yml예제에서name: "{{ metadata.infraID }}-bootstrap"가상 머신을 검사합니다. 여기에는server값이 있는type속성이 이 가상 머신이control_plane프로필에서 상속하는type속성 값을 재정의합니다.

메타 데이터 변수

가상 머신의 경우 metadata.infraID는 Ignition 파일을 빌드할 때 생성한 metadata.json 파일의 인프라 ID를 가상 머신의 이름 앞에 추가합니다.

Playbook은 ocp.assets_dir에 있는 특정 파일에서 infraID 읽고 다음 코드를 사용합니다.

---

- name: include metadata.json vars

include_vars:

file: "{{ ocp.assets_dir }}/metadata.json"

name: metadata

...16.4.12. RHCOS 이미지 설정 지정

inventory.yml 파일의 RHCOS (Red Hat Enterprise Linux CoreOS) 이미지 설정을 업데이트합니다. 나중에 Playbook 중 파일 하나를 실행하면 image_url URL에서 local_cmp_image_path 디렉터리로 압축된 Red Hat Enterprise 리눅스 CoreOS(RHCOS) 이미지가 다운로드됩니다. 그런 다음 Playbook은 이미지를 local_image_path 디렉터리에 압축 해제하고 이를 사용하여 oVirt/RHV 템플릿을 만듭니다.

절차

- 설치 중인 OpenShift Container Platform 버전에 대한 RHCOS 이미지 다운로드 페이지(예: Index of /pub/openshift-v4/dependencies/rhcos/latest/latest)를 찾습니다.

-

해당 다운로드 페이지에서

https://mirror.openshift.com/pub/openshift-v4/dependencies/rhcos/4.9/latest/rhcos-openstack.x86_64.qcow2.gz와 같은 OpenStackqcow2이미지의 URL을 복사합니다. 이전에 다운로드 한

inventory.ymlPlaybook을 편집합니다. 여기에 URL을image_url값으로 붙여 넣습니다. 예를 들면 다음과 같습니다.rhcos: "https://mirror.openshift.com/pub/openshift-v4/dependencies/rhcos/4.9/latest/rhcos-openstack.x86_64.qcow2.gz"

16.4.13. 설치 구성 파일 만들기

설치 프로그램 openshift-install을 실행하고 이전에 지정했거나 수집한 정보로 해당 프롬프트에 응답하여 설치 구성 파일을 만듭니다.

프롬프트에 대한 응답을 마치면 설치 프로그램이 이전에 지정한 assets 디렉터리 (예 : ./wrk/install-config.yaml)에 install-config.yaml 파일의 초기 버전을 생성합니다.

설치 프로그램은 $HOME/.ovirt/ovirt-config.yaml 파일을 생성합니다. 이 파일에는 Manager에 연결하여 REST API를 사용하는 데 필요한 모든 연결 매개 변수가 포함되어 있습니다.

참고: 설치 프로세스는 Internal API virtual IP 및 Ingress virtual IP와 같은 일부 매개 변수에 제공하는 값을 사용하지 않습니다. 이미 인프라 DNS에서 구성했기 때문입니다.

또한 oVirt cluster, oVirt storage 및 oVirt network에 대한 값과 같이 inventory.yml의 매개 변수에 제공하는 값을 사용합니다. 그리고 스크립트를 사용하여 install-config.yaml에서 이러한 동일한 값을 이전에 언급한 virtual IP로 제거하거나 변경합니다.

절차

설치 프로그램을 실행합니다.

$ openshift-install create install-config --dir $ASSETS_DIR시스템에 대한 정보를 사용하여 설치 프로그램의 프롬프트 메시지에 응답합니다.

출력 예

? SSH Public Key /home/user/.ssh/id_dsa.pub ? Platform <ovirt> ? Engine FQDN[:PORT] [? for help] <engine.fqdn> ? Enter ovirt-engine username <ocpadmin@internal> ? Enter password <******> ? oVirt cluster <cluster> ? oVirt storage <storage> ? oVirt network <net> ? Internal API virtual IP <172.16.0.252> ? Ingress virtual IP <172.16.0.251> ? Base Domain <example.org> ? Cluster Name <ocp4> ? Pull Secret [? for help] <********>

? SSH Public Key /home/user/.ssh/id_dsa.pub

? Platform <ovirt>

? Engine FQDN[:PORT] [? for help] <engine.fqdn>

? Enter ovirt-engine username <ocpadmin@internal>

? Enter password <******>

? oVirt cluster <cluster>

? oVirt storage <storage>

? oVirt network <net>

? Internal API virtual IP <172.16.0.252>

? Ingress virtual IP <172.16.0.251>

? Base Domain <example.org>

? Cluster Name <ocp4>

? Pull Secret [? for help] <********>

Internal API virtual IP 및 Ingress virtual IP의 경우 DNS 서비스를 구성할 때 지정한 IP 주소를 제공합니다.

oVirt cluster 및 Base Domain 프롬프트에서 입력한 값은 REST API 및 생성하는 모든 애플리케이션의 URL의 일부를 구성합니다. (예: https://api.ocp4.example.org:6443/ 및 https://console-openshift-console.apps.ocp4.example.org)

Red Hat OpenShift Cluster Manager에서 풀 시크릿을 가져올 수 있습니다.

16.4.14. install-config.yaml 사용자 정의

여기에서는 3 개의 Python 스크립트를 사용하여 설치 프로그램의 일부 기본 동작을 재정의합니다.

- 기본적으로 설치 프로그램은 머신 API를 사용하여 노드를 만듭니다. 이 기본 동작을 재정의하려면 컴퓨팅 노드 수를 복제본 0으로 설정합니다. 나중에 Anable Playbook을 사용하여 컴퓨팅 노드를 생성합니다.

- 기본적으로 설치 프로그램은 노드의 시스템 네트워크의 IP 범위를 설정합니다. 이 기본 동작을 재정의하려면 인프라와 일치하도록 IP 범위를 설정합니다.

-

기본적으로 설치 프로그램은 플랫폼을

ovirt로 설정합니다. 그러나 사용자 프로비저닝 인프라에 클러스터를 설치하는 것은 베어 메탈에 클러스터를 설치하는 것과 비슷합니다. 따라서install-config.yaml에서 ovirt 플랫폼 섹션을 삭제하고 플랫폼을none으로 변경합니다. 대신inventory.yml을 사용하여 모든 필수 설정을 지정합니다.

이 스니펫은 Python 3 및 Python 2에서 작동합니다.

절차

컴퓨팅 노드 수를 복제본 0으로 설정합니다.

$ python3 -c 'import os, yaml path = "%s/install-config.yaml" % os.environ["ASSETS_DIR"] conf = yaml.safe_load(open(path)) conf["compute"][0]["replicas"] = 0 open(path, "w").write(yaml.dump(conf, default_flow_style=False))'머신 네트워크의 IP 범위를 설정합니다. 예를 들어 범위를

172.16.0.0/16으로 설정하려면 다음을 입력합니다.$ python3 -c 'import os, yaml path = "%s/install-config.yaml" % os.environ["ASSETS_DIR"] conf = yaml.safe_load(open(path)) conf["networking"]["machineNetwork"][0]["cidr"] = "172.16.0.0/16" open(path, "w").write(yaml.dump(conf, default_flow_style=False))'ovirt섹션을 제거하고 플랫폼을none으로 변경합니다.$ python3 -c 'import os, yaml path = "%s/install-config.yaml" % os.environ["ASSETS_DIR"] conf = yaml.safe_load(open(path)) platform = conf["platform"] del platform["ovirt"] platform["none"] = {} open(path, "w").write(yaml.dump(conf, default_flow_style=False))'주의Red Hat Virtualization은 현재 oVirt 플랫폼에서 사용자 프로비저닝 인프라를 사용하여 설치를 지원하지 않습니다. 따라서 플랫폼을

none으로 설정해야 OpenShift Container Platform에서 각 노드를 베어 메탈 노드로 식별하고 클러스터를 베어 메탈 클러스터로 식별할 수 있습니다. 이는 모든 플랫폼에 클러스터를 설치하는 것과 동일하며 다음과 같은 제한 사항이 있습니다.- 클러스터 공급자가 없으므로 각 머신을 수동으로 추가해야 하며 노드 확장 기능이 없습니다.

- oVirt CSI 드라이버가 설치되지 않으며 CSI 기능이 없습니다.

16.4.15. 매니페스트 파일 생성

설치 프로그램을 사용하여 assets 디렉터리에 매니페스트 파일 세트를 생성하십시오.

매니페스트 파일을 생성하는 명령은 install-config.yaml 파일을 사용하기 전에 경고 메시지를 표시합니다.

install-config.yaml 파일을 재사용하려는 경우 매니페스트 파일을 생성하기 전에 해당 파일의 백업 사본을 생성합니다.

프로세스

선택 사항:

install-config.yaml파일의 작업 사본을 만듭니다.$ cp install-config.yaml install-config.yaml.backupassets 디렉터리에 매니페스트 세트를 생성합니다.

$ openshift-install create manifests --dir $ASSETS_DIR이 명령은 다음 메시지를 표시합니다.

출력 예

INFO Consuming Install Config from target directory WARNING Making control-plane schedulable by setting MastersSchedulable to true for Scheduler cluster settings이 명령은 다음 매니페스트 파일을 생성합니다.

출력 예

$ tree . └── wrk ├── manifests │ ├── 04-openshift-machine-config-operator.yaml │ ├── cluster-config.yaml │ ├── cluster-dns-02-config.yml │ ├── cluster-infrastructure-02-config.yml │ ├── cluster-ingress-02-config.yml │ ├── cluster-network-01-crd.yml │ ├── cluster-network-02-config.yml │ ├── cluster-proxy-01-config.yaml │ ├── cluster-scheduler-02-config.yml │ ├── cvo-overrides.yaml │ ├── etcd-ca-bundle-configmap.yaml │ ├── etcd-client-secret.yaml │ ├── etcd-host-service-endpoints.yaml │ ├── etcd-host-service.yaml │ ├── etcd-metric-client-secret.yaml │ ├── etcd-metric-serving-ca-configmap.yaml │ ├── etcd-metric-signer-secret.yaml │ ├── etcd-namespace.yaml │ ├── etcd-service.yaml │ ├── etcd-serving-ca-configmap.yaml │ ├── etcd-signer-secret.yaml │ ├── kube-cloud-config.yaml │ ├── kube-system-configmap-root-ca.yaml │ ├── machine-config-server-tls-secret.yaml │ └── openshift-config-secret-pull-secret.yaml └── openshift ├── 99_kubeadmin-password-secret.yaml ├── 99_openshift-cluster-api_master-user-data-secret.yaml ├── 99_openshift-cluster-api_worker-user-data-secret.yaml ├── 99_openshift-machineconfig_99-master-ssh.yaml ├── 99_openshift-machineconfig_99-worker-ssh.yaml └── openshift-install-manifests.yaml

다음 단계

- 컨트롤 플레인 노드를 예약 불가능하게 설정합니다.

16.4.16. 컨트롤 플레인 노드를 예약 불가능하게 설정하기

컨트롤 플레인 시스템을 수동으로 생성 및 배포하고 있으므로 컨트롤 플레인 노드를 예약할 수 없도록 매니페스트 파일을 구성해야 합니다.

프로세스

컨트롤 플레인 노드를 스케줄 불가능하게하려면 다음을 입력합니다.

$ python3 -c 'import os, yaml path = "%s/manifests/cluster-scheduler-02-config.yml" % os.environ["ASSETS_DIR"] data = yaml.safe_load(open(path)) data["spec"]["mastersSchedulable"] = False open(path, "w").write(yaml.dump(data, default_flow_style=False))'

16.4.17. Ignition 파일 빌드하기

방금 생성 및 수정한 매니페스트 파일에서 Ignition 파일을 빌드하려면 설치 프로그램을 실행합니다. 이 작업은 RHCOS (Red Hat Enterprise Linux CoreOS) 시스템 initramfs 를 생성하여 Ignition 파일을 가져오고 노드를 만드는 데 필요한 구성을 수행합니다.

설치 프로그램은 Ignition 파일 외에도 다음을 생성합니다.

-

oc및kubectl유틸리티를 사용하여 클러스터에 연결하기위한 관리자 인증 정보가 포함된auth디렉터리입니다. -

현재 설치에 대한 OpenShift Container Platform 클러스터 이름, 클러스터 ID 및 인프라 ID와 같은 정보가 포함된

metadata.json파일입니다.

설치 프로세스를 위한 Ansible Playbook은 생성한 가상 머신의 접두사로 infraID 값을 사용합니다. 이는 동일한 oVirt/RHV 클러스터에 여러 설치가 있을 때 이름 지정 충돌을 방지합니다.

Ignition 구성 파일의 인증서는 24 시간 후에 만료됩니다. 첫 번째 인증서 교체가 완료될 수 있도록 클러스터 설치를 완료하고 성능이 저하되지 않은 상태에서 24시간 동안 클러스터를 계속 실행해야 합니다.

프로세스

Ignition 파일을 빌드하려면 다음을 입력합니다.

$ openshift-install create ignition-configs --dir $ASSETS_DIR출력 예

$ tree . └── wrk ├── auth │ ├── kubeadmin-password │ └── kubeconfig ├── bootstrap.ign ├── master.ign ├── metadata.json └── worker.ign

16.4.18. 템플릿 및 가상 머신 생성

inventory.yml에서 변수를 확인한 후 첫 번째 Ansible 프로비저닝 Playbook인 create-templates-and-vms.yml을 실행합니다.

이 Playbook은 $HOME/.ovirt/ovirt-config.yaml의 RHV Manager에 대한 연결 매개 변수를 사용하고 assets 디렉터리에서 metadata.json을 읽습니다.

로컬 Red Hat Enterprise Linux CoreOS (RHCOS) 이미지가 존재하지 않는 경우 Playbook은 inventory.yml의 image_url에서 지정한 URL에서 해당 이미지를 다운로드합니다. 이미지를 추출하여 RHV에 업로드하여 템플릿을 생성합니다.

Playbook은 inventory.yml 파일의 control_plane 및 compute 프로필을 기반으로 템플릿을 생성합니다. 이러한 프로필의 이름이 다른 경우 두 개의 템플릿을 만듭니다.

Playbook이 완료되면 생성된 가상 머신이 중지됩니다. 다른 인프라 요소를 구성하는 데 도움이되는 정보를 얻을 수 있습니다. 예를 들어 가상 머신의 MAC 주소를 가져 와서 가상 머신에 영구 IP 주소를 할당하도록 DHCP를 구성할 수 있습니다.

프로세스

-

inventory.yml의control_plane및compute변수에서type: high_performance의 두 인스턴스를type: server로 변경합니다. 선택 사항: 동일한 클러스터에 여러번 설치를 수행하려는 경우 각 OpenShift Container Platform 설치에 대해 서로 다른 템플릿을 생성합니다.

inventory.yml파일에서template값 앞에infraID를 추가합니다. 예를 들면 다음과 같습니다.control_plane: cluster: "{{ ovirt_cluster }}" memory: 16GiB sockets: 4 cores: 1 template: "{{ metadata.infraID }}-rhcos_tpl" operating_system: "rhcos_x64" ...템플릿 및 가상 머신을 만듭니다.

$ ansible-playbook -i inventory.yml create-templates-and-vms.yml

16.4.19. 부트스트랩 시스템 생성

bootstrap.yml Playbook을 실행하여 부트스트랩 머신을 생성합니다. 이 Playbook은 부트스트랩 가상 머신을 시작하고 assets 디렉터리에서 bootstrap.ign Ignition 파일을 전달합니다. 부트스트랩 노드는 컨트롤 플레인 노드에 Ignition 파일을 제공할 수 있도록 자체적으로 구성됩니다.

부트스트랩 프로세스를 모니터링하려면 RHV 관리 포털의 콘솔을 사용하거나 SSH를 사용하여 가상 머신에 연결합니다.

프로세스

부트스트랩 시스템을 생성합니다.

$ ansible-playbook -i inventory.yml bootstrap.yml관리 포털 또는 SSH에서 콘솔을 사용하여 부트스트랩 머신에 연결합니다.

<bootstrap_ip>를 부트스트랩 노드 IP 주소로 바꿉니다. SSH를 사용하려면 다음을 입력합니다.$ ssh core@<boostrap.ip>부트스트랩 노드에서 릴리스 이미지 서비스에 대한

bootkube.servicejournald 장치 로그를 수집합니다.[core@ocp4-lk6b4-bootstrap ~]$ journalctl -b -f -u release-image.service -u bootkube.service참고부트스트랩 노드의

bootkube.service로그는 etcdconnectionrejectd 오류를 출력하고 부트스트랩 서버가 컨트롤 플레인 노드의 etcd에 연결할 수 없음을 나타냅니다. 각 컨트롤 플레인 노드에서 etcd를 시작하고 노드가 클러스터에 가입되면 오류가 중지됩니다.

16.4.20. 컨트롤 플레인 노드 생성

masters.yml Playbook을 실행하여 컨트롤 플레인 노드를 생성합니다. 이 Playbook은 각 가상 머신에 master.ign Ignition 파일을 전달합니다. Ignition 파일에는 https://api-int.ocp4.example.org:22623/config/master와 같은 URL에서 Ignition을 가져 오는 컨트롤 플레인 노드에 대한 지시문이 포함되어 있습니다. 이 URL의 포트 번호는 로드 밸런서에 의해 관리되며 클러스터 내에서만 액세스할 수 있습니다.

프로세스

컨트롤 플레인 노드를 생성합니다.

$ ansible-playbook -i inventory.yml masters.ymlPlaybook이 컨트롤 플레인을 생성하는 동안 부트스트랩 프로세스를 모니터링합니다.

$ openshift-install wait-for bootstrap-complete --dir $ASSETS_DIR출력 예

INFO API v1.22.1 up INFO Waiting up to 40m0s for bootstrapping to complete...컨트롤 플레인 노드 및 etcd의 모든 pod가 실행 중이면 설치 프로그램에 다음과 같은 출력이 표시됩니다.

출력 예

INFO It is now safe to remove the bootstrap resources

16.4.21. 클러스터 상태 확인

설치 중 또는 설치 후 OpenShift Container Platform 클러스터의 상태를 확인할 수 있습니다.

프로세스

클러스터 환경에서 관리자의 kubeconfig 파일을 내보냅니다.

$ export KUBECONFIG=$ASSETS_DIR/auth/kubeconfigkubeconfig파일에는 CLI에서 올바른 클러스터 및 API 서버에 클라이언트를 연결하는 데 사용하는 클러스터에 대한 정보가 포함되어 있습니다.배포 후 생성된 컨트롤 플레인 및 컴퓨팅 시스템을 확인합니다.

$ oc get nodes클러스터 버전을 확인합니다.

$ oc get clusterversionOperator 상태를 확인합니다.

$ oc get clusteroperator클러스터에서 실행 중인 모든 Pod를 확인합니다.

$ oc get pods -A

16.4.22. 부트스트랩 시스템 제거

wait-for 명령이 부트스트랩 프로세스가 완료되었음을 표시한 후 부트스트랩 가상 머신을 제거하여 컴퓨팅, 메모리 및 스토리지 리소스를 확보해야 합니다. 또한 로드 밸런서 지시문에서 부트스트랩 시스템 설정을 제거해야 합니다.

프로세스

클러스터에서 부트스트랩 시스템을 제거하려면 다음을 입력하십시오.

$ ansible-playbook -i inventory.yml retire-bootstrap.yml- 로드 밸런서 지시문에서 부트스트랩 머신의 설정을 제거합니다.

16.4.23. 작업자 노드 작성 및 설치 완료

작업자 노드 생성은 컨트롤 플레인 노드를 생성하는 것과 유사합니다. 그러나 작업자 노드는 클러스터에 자동으로 참여하지 않습니다. 클러스터에 추가하려면 작업자의 보류중인 CSR (인증서 서명 요청)을 검토하고 승인합니다.

첫 번째 요청을 승인한 후 모든 작업자 노드가 승인될 때까지 CSR을 계속 승인합니다. 이 프로세스를 완료하면 작업자 노드가 Ready 상태가 되고 해당 노드에서 실행되도록 Pod를 예약할 수 있습니다.

마지막으로 명령줄을 모니터링하여 설치 프로세스가 완료되는지 확인합니다.

프로세스

작업자 노드를 생성합니다.

$ ansible-playbook -i inventory.yml workers.yml모든 CSR을 나열하려면 다음을 입력하십시오.

$ oc get csr -A결국이 명령은 노드 당 하나의 CSR을 표시합니다. 예를 들면 다음과 같습니다.

출력 예

NAME AGE SIGNERNAME REQUESTOR CONDITION csr-2lnxd 63m kubernetes.io/kubelet-serving system:node:ocp4-lk6b4-master0.ocp4.example.org Approved,Issued csr-hff4q 64m kubernetes.io/kube-apiserver-client-kubelet system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Approved,Issued csr-hsn96 60m kubernetes.io/kubelet-serving system:node:ocp4-lk6b4-master2.ocp4.example.org Approved,Issued csr-m724n 6m2s kubernetes.io/kube-apiserver-client-kubelet system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending csr-p4dz2 60m kubernetes.io/kube-apiserver-client-kubelet system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Approved,Issued csr-t9vfj 60m kubernetes.io/kubelet-serving system:node:ocp4-lk6b4-master1.ocp4.example.org Approved,Issued csr-tggtr 61m kubernetes.io/kube-apiserver-client-kubelet system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Approved,Issued csr-wcbrf 7m6s kubernetes.io/kube-apiserver-client-kubelet system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending목록을 필터링하고 보류중인 CSR 만 보려면 다음을 입력하십시오.

$ watch "oc get csr -A | grep pending -i"이 명령은 2 초마다 출력을 새로 고침하고 보류중인 CSR 만 표시합니다. 예를 들면 다음과 같습니다.

출력 예

Every 2.0s: oc get csr -A | grep pending -i csr-m724n 10m kubernetes.io/kube-apiserver-client-kubelet system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending csr-wcbrf 11m kubernetes.io/kube-apiserver-client-kubelet system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Pending보류 중인 각 요청을 검사합니다. 예를 들면 다음과 같습니다.

출력 예

$ oc describe csr csr-m724n출력 예

Name: csr-m724n Labels: <none> Annotations: <none> CreationTimestamp: Sun, 19 Jul 2020 15:59:37 +0200 Requesting User: system:serviceaccount:openshift-machine-config-operator:node-bootstrapper Signer: kubernetes.io/kube-apiserver-client-kubelet Status: Pending Subject: Common Name: system:node:ocp4-lk6b4-worker1.ocp4.example.org Serial Number: Organization: system:nodes Events: <none>CSR 정보가 정확하면 다음 요청을 승인합니다.

$ oc adm certificate approve csr-m724n설치 프로세스가 완료될 때까지 기다립니다.

$ openshift-install wait-for install-complete --dir $ASSETS_DIR --log-level debug설치가 완료되면 명령행에 OpenShift Container Platform 웹 콘솔의 URL과 관리자 이름 및 암호가 표시됩니다.

16.4.24. OpenShift Container Platform의 Telemetry 액세스

OpenShift Container Platform 4.9에서는 클러스터 상태 및 업데이트 진행에 대한 메트릭을 제공하기 위해 기본적으로 실행되는 Telemetry 서비스에 인터넷 액세스가 필요합니다. 클러스터가 인터넷에 연결되어 있으면 Telemetry가 자동으로 실행되고 OpenShift Cluster Manager 에 클러스터가 자동으로 등록됩니다.

OpenShift Cluster Manager 인벤토리가 올바르거나 OpenShift Cluster Manager를 사용하여 자동으로 또는 OpenShift Cluster Manager를 사용하여 수동으로 유지 관리되는지 확인한 후 subscription watch를 사용하여 계정 또는 다중 클러스터 수준에서 OpenShift Container Platform 서브스크립션을 추적합니다.