2.5. 네트워크 사용자 지정으로 vSphere에 클러스터 설치

OpenShift Container Platform 버전 4.15에서는 사용자 지정 네트워크 구성 옵션이 있는 설치 관리자 프로비저닝 인프라를 사용하여 VMware vSphere 인스턴스에 클러스터를 설치할 수 있습니다. 네트워크 구성을 사용자 지정할 경우, 클러스터가 사용자 환경의 기존 IP 주소 할당과 공존하고 기존 MTU 및 VXLAN 구성과 통합될 수 있습니다. 설치를 사용자 지정하려면 클러스터를 설치하기 전에 install-config.yaml 파일에서 매개변수를 수정합니다.

설치 과정에서 네트워크 구성 매개변수를 대부분 설정해야 하며, 실행 중인 클러스터에서는 kubeProxy 구성 매개변수만 수정할 수 있습니다.

OpenShift Container Platform은 단일 VMware vCenter에만 클러스터 배포를 지원합니다. 여러 vCenter에 머신/머신 세트로 클러스터를 배포하는 것은 지원되지 않습니다.

2.5.1. 사전 요구 사항

- 설치 관리자 프로비저닝 인프라를 사용하여 클러스터 설치 준비 작업을 완료했습니다.

- VMware 플랫폼 라이센스를 검토했습니다. Red Hat은 VMware 라이센스에 제한이 없지만 일부 VMware 인프라 구성 요소에는 라이센스가 필요합니다.

- OpenShift Container Platform 설치 및 업데이트 프로세스에 대한 세부 사항을 검토했습니다.

- 클러스터 설치 방법 선택 및 사용자를 위한 준비에 대한 문서를 읽습니다.

-

클러스터용 영구 스토리지를 프로비저닝합니다. 프라이빗 이미지 레지스트리를 배포하려면 스토리지에서

ReadWriteMany액세스 모드를 제공해야 합니다. - OpenShift Container Platform 설치 프로그램은 vCenter 및 ESXi 호스트의 포트 443에 액세스해야 합니다. 포트 443에 액세스할 수 있는지 확인합니다.

- 방화벽을 사용하는 경우 관리자가 443 포트에 액세스할 수 있는지 확인합니다. 컨트롤 플레인 노드는 설치에 성공하려면 포트 443에서 vCenter 및 ESXi 호스트에 연결할 수 있어야 합니다.

방화벽을 사용하는 경우 클러스터가 액세스해야 하는 사이트를 허용하도록 방화벽을 구성했습니다.

참고프록시를 구성하는 경우에도 해당 사이트 목록을 검토하십시오.

2.5.2. OpenShift Container Platform 용 인터넷 액세스

OpenShift Container Platform 4.15에서 클러스터를 설치하려면 인터넷 액세스가 필요합니다.

다음의 경우 인터넷 액세스가 필요합니다.

- OpenShift Cluster Manager 에 액세스하여 설치 프로그램을 다운로드하고 서브스크립션 관리를 수행합니다. 클러스터가 인터넷에 액세스할 수 있고 Telemetry 서비스를 비활성화하지 않은 경우, 클러스터에 자동으로 권한이 부여됩니다.

- Quay.io에 액세스. 클러스터를 설치하는 데 필요한 패키지를 받을 수 있습니다.

- 클러스터 업데이트를 수행하는 데 필요한 패키지를 받을 수 있습니다.

클러스터가 직접 인터넷에 액세스할 수 없는 경우, 프로비저닝하는 일부 유형의 인프라에서 제한된 네트워크 설치를 수행할 수 있습니다. 이 프로세스 동안 필요한 콘텐츠를 다운로드하고 이를 사용하여 설치 패키지로 미러 레지스트리를 채웁니다. 설치 유형에 따라서는 클러스터를 설치하는 환경에 인터넷 액세스가 필요하지 않을 수도 있습니다. 클러스터를 업데이트하기 전에 미러 레지스트리의 내용을 업데이트합니다.

2.5.3. VMware vSphere 리전 및 영역 활성화

단일 VMware vCenter에서 실행되는 여러 vSphere 데이터센터에 OpenShift Container Platform 클러스터를 배포할 수 있습니다. 각 데이터센터는 여러 클러스터를 실행할 수 있습니다. 이 구성을 사용하면 클러스터에 실패할 수 있는 하드웨어 장애 또는 네트워크 중단 위험이 줄어듭니다. 리전 및 영역을 활성화하려면 OpenShift Container Platform 클러스터에 대해 여러 장애 도메인을 정의해야 합니다.

VMware vSphere 리전 및 영역 활성화 기능에는 클러스터의 기본 스토리지 드라이버로 vSphere CSI(Container Storage Interface) 드라이버가 필요합니다. 결과적으로 이 기능은 새로 설치된 클러스터에서만 사용할 수 있습니다.

이전 릴리스에서 업그레이드된 클러스터의 경우 클러스터에 대해 CSI 자동 마이그레이션을 활성화해야 합니다. 그런 다음 업그레이드된 클러스터에 대해 여러 리전 및 영역을 구성할 수 있습니다.

기본 설치 구성은 클러스터를 단일 vSphere 데이터 센터에 배포합니다. 여러 vSphere 데이터 센터에 클러스터를 배포하려면 리전 및 영역 기능을 활성화하는 설치 구성 파일을 생성해야 합니다.

기본 install-config.yaml 파일에는 vcenters 및 failureDomains 필드가 포함되어 있습니다. 여기서 OpenShift Container Platform 클러스터에 대해 여러 vSphere 데이터 센터 및 클러스터를 지정할 수 있습니다. 단일 데이터 센터로 구성된 vSphere 환경에 OpenShift Container Platform 클러스터를 설치하려는 경우 이러한 필드를 비워 둘 수 있습니다.

다음 목록은 클러스터의 영역 및 지역 정의와 관련된 용어를 설명합니다.

-

실패 도메인: 지역과 영역 간의 관계를 구축합니다.

datastore오브젝트와 같은 vCenter 오브젝트를 사용하여 실패 도메인을 정의합니다. 장애 도메인은 OpenShift Container Platform 클러스터 노드의 vCenter 위치를 정의합니다. -

region: vCenter 데이터 센터를 지정합니다.

openshift-region태그 범주의 태그를 사용하여 리전을 정의합니다. -

zone: vCenter 클러스터를 지정합니다.

openshift-zone태그 범주의 태그를 사용하여 영역을 정의합니다.

install-config.yaml 파일에 둘 이상의 실패 도메인을 지정하려는 경우 구성 파일을 생성하기 전에 태그 카테고리, 영역 태그 및 지역 태그를 생성해야 합니다.

리전을 나타내는 각 vCenter 데이터 센터에 vCenter 태그를 생성해야 합니다. 또한 각 클러스터에 대해 영역을 나타내는 데이터 센터에서 실행되는 것보다 vCenter 태그를 생성해야 합니다. 태그를 생성한 후 각 태그를 해당 데이터 센터 및 클러스터에 연결해야 합니다.

다음 표에서는 단일 VMware vCenter에서 실행되는 여러 vSphere 데이터 센터가 있는 구성의 지역, 영역 및 태그 간의 관계에 대한 예를 간략하게 설명합니다.

| 데이터 센터 (지역) | 클러스터 (zone) | 태그 |

|---|---|---|

| us-east | us-east-1 | us-east-1a |

| us-east-1b | ||

| us-east-2 | us-east-2a | |

| us-east-2b | ||

| us-west | us-west-1 | us-west-1a |

| us-west-1b | ||

| us-west-2 | us-west-2a | |

| us-west-2b |

2.5.4. 설치 구성 파일 만들기

VMware vSphere에 설치하는 OpenShift Container Platform 클러스터를 사용자 지정할 수 있습니다.

사전 요구 사항

- OpenShift Container Platform 설치 프로그램과 클러스터의 풀 시크릿이 있습니다.

프로세스

install-config.yaml파일을 생성합니다.설치 프로그램이 포함된 디렉터리로 변경하고 다음 명령을 실행합니다.

$ ./openshift-install create install-config --dir <installation_directory>1 - 1

<installation_directory>는 설치 프로그램이 생성하는 파일을 저장할 디렉터리 이름을 지정합니다.

디렉터리를 지정할 때 다음을 수행합니다.

-

디렉터리에

execute권한이 있는지 확인합니다. 설치 디렉토리에서 Terraform 바이너리를 실행하려면 이 권한이 필요합니다. - 빈 디렉터리를 사용합니다. 부트스트랩 X.509 인증서와 같은 일부 설치 자산은 단기간에 만료되므로 설치 디렉터리를 재사용해서는 안 됩니다. 다른 클러스터 설치의 개별 파일을 재사용하려면 해당 파일을 사용자 디렉터리에 복사하면 됩니다. 그러나 설치 자산의 파일 이름은 릴리스간에 변경될 수 있습니다. 따라서 이전 OpenShift Container Platform 버전에서 설치 파일을 복사할 때는 주의하십시오.

화면에 나타나는 지시에 따라 클라우드에 대한 구성 세부 사항을 입력합니다.

선택사항: 클러스터 시스템에 액세스하는 데 사용할 SSH 키를 선택합니다.

참고설치 디버깅 또는 재해 복구를 수행하려는 프로덕션 OpenShift Container Platform 클러스터의 경우

ssh-agent프로세스가 사용하는 SSH 키를 지정합니다.- 대상 플랫폼으로 vsphere를 선택합니다.

- vCenter 인스턴스의 이름을 지정합니다.

클러스터를 생성하는 데 필요한 권한이 있는 vCenter 계정의 사용자 이름과 암호를 지정합니다.

설치 프로그램이 vCenter 인스턴스에 연결됩니다.

연결할 vCenter 인스턴스에서 데이터 센터를 선택합니다.

참고설치 구성 파일을 생성한 후 파일을 수정하여 여러 vSphere 데이터 센터 환경을 생성할 수 있습니다. 즉, 단일 VMware vCenter에서 실행되는 여러 vSphere 데이터 센터에 OpenShift Container Platform 클러스터를 배포할 수 있습니다. 이 환경 생성에 대한 자세한 내용은 VMware vSphere 리전 및 영역 활성화 섹션을 참조하십시오.

사용할 기본 vCenter 데이터 저장소를 선택합니다.

주의데이터 저장소 클러스터에 존재하는 모든 데이터 저장소의 경로를 지정할 수 있습니다. 기본적으로 스토리지 vMotion을 사용하는 SDRS(Storage Distributed Resource Scheduler)는 데이터 저장소 클러스터에 대해 자동으로 활성화됩니다. Red Hat은 스토리지 vMotion을 지원하지 않으므로 OpenShift Container Platform 클러스터의 데이터 손실 문제를 방지하려면 스토리지 DRS를 비활성화해야 합니다.

데이터 저장소 경로를 두 개 이상 지정할 수 없습니다. 여러 데이터 저장소에서 VM을 지정해야 하는 경우

datastore오브젝트를 사용하여 클러스터의install-config.yaml구성 파일에 실패 도메인을 지정합니다. 자세한 내용은 "VMware vSphere 리전 및 영역 활성화"를 참조하십시오.- OpenShift Container Platform 클러스터를 설치할 vCenter 클러스터를 선택합니다. 설치 프로그램은 vSphere 클러스터의 루트 리소스 풀을 기본 리소스 풀로 사용합니다.

- vCenter 인스턴스에서 구성한 가상 IP 주소 및 DNS 레코드가 포함된 네트워크를 선택합니다.

- 컨트롤 플레인 API 액세스를 위해 구성한 가상 IP 주소를 입력합니다.

- 클러스터 인그레스용으로 구성한 가상 IP 주소를 입력합니다.

- 기본 도메인을 입력합니다. 이 기본 도메인은 구성한 DNS 레코드에서 사용한 것과 동일해야 합니다.

클러스터를 설명할 수 있는 이름을 입력합니다.

입력한 클러스터 이름은 DNS 레코드를 구성할 때 지정한 클러스터 이름과 일치해야 합니다.

-

install-config.yaml파일을 수정합니다. 사용 가능한 매개변수에 대한 자세한 정보는 “설치 구성 매개변수” 섹션에서 확인할 수 있습니다. 여러 클러스터를 설치하는 데 사용할 수 있도록

install-config.yaml파일을 백업합니다.중요install-config.yaml파일은 설치 과정에서 사용됩니다. 이 파일을 재사용하려면 지금 백업해야 합니다.

2.5.4.1. 설치 관리자 프로비저닝 VMware vSphere 클러스터의 샘플 install-config.yaml 파일

install-config.yaml 파일을 사용자 지정하여 OpenShift Container Platform 클러스터 플랫폼에 대한 자세한 정보를 지정하거나 필수 매개변수 값을 수정할 수 있습니다.

apiVersion: v1

baseDomain: example.com

compute:

- architecture: amd64

name: <worker_node>

platform: {}

replicas: 3

controlPlane:

architecture: amd64

name: <parent_node>

platform: {}

replicas: 3

metadata:

creationTimestamp: null

name: test

networking:

clusterNetwork:

- cidr: 10.128.0.0/14

hostPrefix: 23

machineNetwork:

- cidr: 10.0.0.0/16

networkType: OVNKubernetes

serviceNetwork:

- 172.30.0.0/16

platform:

vsphere:

apiVIPs:

- 10.0.0.1

failureDomains:

- name: <failure_domain_name>

region: <default_region_name>

server: <fully_qualified_domain_name>

topology:

computeCluster: "/<datacenter>/host/<cluster>"

datacenter: <datacenter>

datastore: "/<datacenter>/datastore/<datastore>"

networks:

- <VM_Network_name>

resourcePool: "/<datacenter>/host/<cluster>/Resources/<resourcePool>"

folder: "/<datacenter_name>/vm/<folder_name>/<subfolder_name>"

zone: <default_zone_name>

ingressVIPs:

- 10.0.0.2

vcenters:

- datacenters:

- <datacenter>

password: <password>

port: 443

server: <fully_qualified_domain_name>

user: administrator@vsphere.local

diskType: thin

fips: false

pullSecret: '{"auths": ...}'

sshKey: 'ssh-ed25519 AAAA...'- 1

- 클러스터의 기본 도메인입니다. 모든 DNS 레코드는 이 기본 도메인의 하위 도메인이어야 하며 클러스터 이름을 포함해야 합니다.

- 2 3

controlPlane섹션은 단일 매핑이지만compute섹션은 일련의 매핑입니다. 서로 다른 데이터 구조의 요구사항을 충족하도록compute섹션의 첫 번째 줄은 하이픈(-)으로 시작해야 하며controlPlane섹션의 첫 번째 줄은 하이픈으로 시작할 수 없습니다. 하나의 컨트롤 플레인 풀만 사용됩니다.- 4

- DNS 레코드에 지정한 클러스터 이름입니다.

- 6

- 선택 사항: 컴퓨팅 및 컨트롤 플레인 시스템의 머신 풀 매개변수에 대한 추가 구성을 제공합니다.

- 7

- 지역과 영역 간의 관계를 설정합니다.

datastore오브젝트와 같은 vCenter 오브젝트를 사용하여 실패 도메인을 정의합니다. 장애 도메인은 OpenShift Container Platform 클러스터 노드의 vCenter 위치를 정의합니다. - 8

- 가상 머신 파일, 템플릿 및 ISO 이미지를 보유하는 vSphere 데이터 저장소의 경로입니다.중요

데이터 저장소 클러스터에 존재하는 모든 데이터 저장소의 경로를 지정할 수 있습니다. 기본적으로 데이터 저장소 클러스터에 대해 스토리지 vMotion이 자동으로 활성화됩니다. Red Hat은 스토리지 vMotion을 지원하지 않으므로 OpenShift Container Platform 클러스터의 데이터 손실 문제를 방지하려면 스토리지 vMotion을 비활성화해야 합니다.

여러 데이터 저장소에서 VM을 지정해야 하는 경우

datastore오브젝트를 사용하여 클러스터의install-config.yaml구성 파일에 실패 도메인을 지정합니다. 자세한 내용은 "VMware vSphere 리전 및 영역 활성화"를 참조하십시오. - 9

- 선택 사항: 머신 생성을 위한 기존 리소스 풀을 제공합니다. 값을 지정하지 않으면 설치 프로그램은 vSphere 클러스터의 루트 리소스 풀을 사용합니다.

- 10

- vSphere 디스크 프로비저닝 방법입니다.

- 5

- 설치할 클러스터 네트워크 플러그인입니다. 기본 값

OVNKubernetes는 지원되는 유일한 값입니다.

OpenShift Container Platform 4.12 이상에서는 apiVIP 및 ingressVIP 구성 설정이 더 이상 사용되지 않습니다. 대신 목록 형식을 사용하여 apiVIPs 및 ingressVIPs 구성 설정에 값을 입력합니다.

2.5.4.2. 설치 중 클러스터 단위 프록시 구성

프로덕션 환경에서는 인터넷에 대한 직접 액세스를 거부하고 대신 HTTP 또는 HTTPS 프록시를 사용할 수 있습니다. install-config.yaml 파일에서 프록시 설정을 구성하여 프록시가 사용되도록 새 OpenShift Container Platform 클러스터를 구성할 수 있습니다.

사전 요구 사항

-

기존

install-config.yaml파일이 있습니다. 클러스터에서 액세스해야 하는 사이트를 검토하고 프록시를 바이패스해야 하는지 확인했습니다. 기본적으로 호스팅 클라우드 공급자 API에 대한 호출을 포함하여 모든 클러스터 발신(Egress) 트래픽이 프록시됩니다. 필요한 경우 프록시를 바이패스하기 위해

Proxy오브젝트의spec.noProxy필드에 사이트를 추가했습니다.참고Proxy오브젝트의status.noProxy필드는 설치 구성에 있는networking.machineNetwork[].cidr,networking.clusterNetwork[].cidr,networking.serviceNetwork[]필드의 값으로 채워집니다.AWS(Amazon Web Services), Google Cloud, Microsoft Azure 및 RHOSP(Red Hat OpenStack Platform)에 설치하는 경우

프록시오브젝트status.noProxy필드도 인스턴스 메타데이터 끝점(169.254.169.254)으로 채워집니다.

프로세스

install-config.yaml파일을 편집하고 프록시 설정을 추가합니다. 예를 들면 다음과 같습니다.apiVersion: v1 baseDomain: my.domain.com proxy: httpProxy: http://<username>:<pswd>@<ip>:<port>1 httpsProxy: https://<username>:<pswd>@<ip>:<port>2 noProxy: example.com3 additionalTrustBundle: |4 -----BEGIN CERTIFICATE----- <MY_TRUSTED_CA_CERT> -----END CERTIFICATE----- additionalTrustBundlePolicy: <policy_to_add_additionalTrustBundle>5 - 1

- 클러스터 외부에서 HTTP 연결을 구축하는 데 사용할 프록시 URL입니다. URL 스키마는

http여야 합니다. - 2

- 클러스터 외부에서 HTTPS 연결을 구축하는 데 사용할 프록시 URL입니다.

- 3

- 대상 도메인 이름, IP 주소 또는 프록시에서 제외할 기타 네트워크 CIDR로 이루어진 쉼표로 구분된 목록입니다. 하위 도메인과 일치하려면 도메인 앞에

.을 입력합니다. 예를 들어,.y.com은x.y.com과 일치하지만y.com은 일치하지 않습니다.*를 사용하여 모든 대상에 대해 프록시를 바이패스합니다. vCenter의 IP 주소와 해당 시스템에 사용하는 IP 범위를 포함해야 합니다. - 4

- 이 값을 제공하면 설치 프로그램에서 HTTPS 연결을 프록시하는 데 필요한 추가 CA 인증서가 하나 이상 포함된

openshift-config네임스페이스에user-ca-bundle이라는 이름으로 구성 맵을 생성합니다. 그러면 CNO(Cluster Network Operator)에서 이러한 콘텐츠를 RHCOS(Red Hat Enterprise Linux CoreOS) 신뢰 번들과 병합하는trusted-ca-bundle구성 맵을 생성합니다. 이 구성 맵은Proxy오브젝트의trustedCA필드에서 참조됩니다. 프록시의 ID 인증서를 RHCOS 트러스트 번들에 있는 기관에서 서명하지 않은 경우additionalTrustBundle필드가 있어야 합니다. - 5

- 선택 사항:

trustedCA필드에서user-ca-bundle구성 맵을 참조할프록시오브젝트의 구성을 결정하는 정책입니다. 허용되는 값은Proxyonly및Always입니다.http/https프록시가 구성된 경우에만user-ca-bundle구성 맵을 참조하려면Proxyonly를 사용합니다.Always를 사용하여user-ca-bundle구성 맵을 항상 참조합니다. 기본값은Proxyonly입니다.

참고설치 프로그램에서 프록시

adinessEndpoints필드를 지원하지 않습니다.참고설치 프로그램이 시간 초과되면 설치 프로그램의

wait-for명령을 사용하여 배포를 다시 시작한 다음 완료합니다. 예를 들면 다음과 같습니다.$ ./openshift-install wait-for install-complete --log-level debug- 파일을 저장해 놓고 OpenShift Container Platform을 설치할 때 참조하십시오.

제공되는 install-config.yaml 파일의 프록시 설정을 사용하는 cluster라는 이름의 클러스터 전체 프록시가 설치 프로그램에 의해 생성됩니다. 프록시 설정을 제공하지 않아도 cluster Proxy 오브젝트는 계속 생성되지만 spec은 nil이 됩니다.

cluster라는 Proxy 오브젝트만 지원되며 추가 프록시는 생성할 수 없습니다.

2.5.4.3. 듀얼 스택 네트워킹을 사용하여 IP 주소 지정 배포

부트스트랩 가상 머신(VM)의 듀얼 스택 네트워킹을 사용하여 IP 주소 지정을 배포할 때 부트스트랩 VM은 단일 IP 버전으로 작동합니다.

다음 예제는 DHCP용입니다. DHCP 기반 듀얼 스택 클러스터는 1일 차부터 각각 하나의 IPv4 및 하나의 IPv6 가상 IP 주소(VIP)를 사용하여 배포할 수 있습니다.

고정 IP 주소로 클러스터를 배포하려면 부트스트랩 VM, API 및 Ingress VIP의 IP 주소를 구성해야 합니다. install-config 에 설정된 고정 IP를 사용하여 듀얼 스택을 구성하려면 API 및 수신에 각각 하나의 VIP가 필요합니다. 배포 후 보조 VIP를 추가합니다.

OpenShift Container Platform 클러스터의 듀얼 스택 네트워킹의 경우 클러스터 노드에 대해 IPv4 및 IPv6 주소 끝점을 구성할 수 있습니다. 클러스터 노드에 대한 IPv4 및 IPv6 주소 끝점을 구성하려면 install-config.yaml 파일에서 machineNetwork,clusterNetwork 및 serviceNetwork 구성 설정을 편집합니다. 각 설정에는 각각 두 개의 CIDR 항목이 있어야 합니다. IPv4 제품군을 기본 주소 제품군으로 사용하는 클러스터의 경우 먼저 IPv4 설정을 지정합니다. IPv6 제품군을 기본 주소 제품군으로 사용하는 클러스터의 경우 먼저 IPv6 설정을 지정합니다.

클러스터 노드의 IPv4 및 IPv6 주소 끝점을 포함하는 NMState YAML 구성 파일의 예

machineNetwork:

- cidr: {{ extcidrnet }}

- cidr: {{ extcidrnet6 }}

clusterNetwork:

- cidr: 10.128.0.0/14

hostPrefix: 23

- cidr: fd02::/48

hostPrefix: 64

serviceNetwork:

- 172.30.0.0/16

- fd03::/112

IPv4 및 IPv6 주소를 사용하는 애플리케이션의 클러스터에 인터페이스를 제공하려면 Ingress VIP 및 API VIP 서비스에 대한 IPv4 및 IPv6 가상 IP(VIP) 주소 끝점을 구성합니다. IPv4 및 IPv6 주소 끝점을 구성하려면 install-config.yaml 파일에서 apiVIPs 및 ingressVIPs 구성 설정을 편집합니다. apiVIPs 및 ingressVIPs 구성 설정은 목록 형식을 사용합니다. 목록 순서는 각 서비스의 기본 및 보조 VIP 주소를 나타냅니다.

platform:

vsphere:

apiVIPs:

- <api_ipv4>

- <api_ipv6>

ingressVIPs:

- <wildcard_ipv4>

- <wildcard_ipv6>듀얼 스택 네트워킹 구성이 있는 클러스터의 경우 IPv4 및 IPv6 주소를 동일한 인터페이스에 할당해야 합니다.

2.5.4.4. VMware vCenter의 지역 및 영역 구성

단일 VMware vCenter에서 실행되는 여러 vSphere 데이터 센터에 OpenShift Container Platform 클러스터를 배포할 수 있도록 기본 설치 구성 파일을 수정할 수 있습니다.

이전 릴리스의 기본 install-config.yaml 파일 구성은 더 이상 사용되지 않습니다. 더 이상 사용되지 않는 기본 구성을 계속 사용할 수 있지만 openshift-installer 는 구성 파일에서 더 이상 사용되지 않는 필드 사용을 나타내는 경고 메시지를 표시합니다.

이 예제에서는 govc 명령을 사용합니다. govc 명령은 VMware에서 사용할 수 있는 오픈 소스 명령이며 Red Hat에서 사용할 수 없습니다. Red Hat 지원 팀은 govc 명령을 유지 관리하지 않습니다. govc 다운로드 및 설치 지침은 VMware 설명서 웹 사이트에서 확인할 수 있습니다.

사전 요구 사항

기존

install-config.yaml설치 구성 파일이 있습니다.중요VMware vCenter 서버의 데이터 센터 오브젝트를 프로비저닝할 수 있도록 OpenShift Container Platform 클러스터에 대해 하나 이상의 실패 도메인을 지정해야 합니다. 다른 데이터 센터, 클러스터, 데이터 저장소 및 기타 구성 요소에서 가상 머신 노드를 프로비저닝해야 하는 경우 여러 장애 도메인을 지정하는 것이 좋습니다. 리전 및 영역을 활성화하려면 OpenShift Container Platform 클러스터에 대해 여러 장애 도메인을 정의해야 합니다.

프로세스

다음

govc명령줄 툴 명령을 입력하여openshift-region및openshift-zonevCenter 태그 범주를 생성합니다.중요openshift-region및openshift-zonevCenter 태그 카테고리에 다른 이름을 지정하면 OpenShift Container Platform 클러스터 설치가 실패합니다.$ govc tags.category.create -d "OpenShift region" openshift-region$ govc tags.category.create -d "OpenShift zone" openshift-zone클러스터를 배포하려는 각 리전 vSphere 데이터 센터의 리전 태그를 생성하려면 터미널에 다음 명령을 입력합니다.

$ govc tags.create -c <region_tag_category> <region_tag>클러스터를 배포하려는 각 vSphere 클러스터에 대한 영역 태그를 생성하려면 다음 명령을 입력합니다.

$ govc tags.create -c <zone_tag_category> <zone_tag>다음 명령을 입력하여 각 vCenter 데이터 센터 오브젝트에 리전 태그를 연결합니다.

$ govc tags.attach -c <region_tag_category> <region_tag_1> /<datacenter_1>다음 명령을 입력하여 각 vCenter 데이터 센터 오브젝트에 영역 태그를 연결합니다.

$ govc tags.attach -c <zone_tag_category> <zone_tag_1> /<datacenter_1>/host/vcs-mdcnc-workload-1- 설치 프로그램이 포함된 디렉터리로 변경하고 선택한 설치 요구 사항에 따라 클러스터 배포를 초기화합니다.

vSphere 센터에 정의된 여러 데이터 센터가 있는 샘플 install-config.yaml 파일

# ...

compute:

---

vsphere:

zones:

- "<machine_pool_zone_1>"

- "<machine_pool_zone_2>"

# ...

controlPlane:

# ...

vsphere:

zones:

- "<machine_pool_zone_1>"

- "<machine_pool_zone_2>"

# ...

platform:

vsphere:

vcenters:

# ...

datacenters:

- <datacenter1_name>

- <datacenter2_name>

failureDomains:

- name: <machine_pool_zone_1>

region: <region_tag_1>

zone: <zone_tag_1>

server: <fully_qualified_domain_name>

topology:

datacenter: <datacenter1>

computeCluster: "/<datacenter1>/host/<cluster1>"

networks:

- <VM_Network1_name>

datastore: "/<datacenter1>/datastore/<datastore1>"

resourcePool: "/<datacenter1>/host/<cluster1>/Resources/<resourcePool1>"

folder: "/<datacenter1>/vm/<folder1>"

- name: <machine_pool_zone_2>

region: <region_tag_2>

zone: <zone_tag_2>

server: <fully_qualified_domain_name>

topology:

datacenter: <datacenter2>

computeCluster: "/<datacenter2>/host/<cluster2>"

networks:

- <VM_Network2_name>

datastore: "/<datacenter2>/datastore/<datastore2>"

resourcePool: "/<datacenter2>/host/<cluster2>/Resources/<resourcePool2>"

folder: "/<datacenter2>/vm/<folder2>"

---2.5.5. 네트워크 구성 단계

OpenShift Container Platform을 설치하기 전에 네트워크 구성을 사용자 지정할 수 있습니다.

- 1 단계

매니페스트 파일을 생성하기 전에

install-config.yaml파일에서 다음 네트워크 관련 필드를 사용자 지정할 수 있습니다.-

networking.networkType -

networking.clusterNetwork -

networking.serviceNetwork networking.machineNetwork자세한 내용은 "설치 구성 매개변수"를 참조하십시오.

참고기본 서브넷이 있는 CIDR(Classless Inter-Domain Routing)과 일치하도록

networking.machineNetwork를 설정합니다.중요CIDR 범위

172.17.0.0/16은libVirt에 의해 예약되어 있습니다. 클러스터의 네트워크에172.17.0.0/16CIDR 범위와 겹치는 다른 CIDR 범위는 사용할 수 없습니다.

-

- 2 단계

-

openshift-install create manifests 를실행하여 매니페스트 파일을 생성한 후 수정할 필드로 사용자 지정된 Cluster Network Operator 매니페스트를 정의할 수 있습니다. 매니페스트를 사용하여 고급 네트워크 구성을 지정할 수 있습니다.

2 단계에서는 install-config.yaml 파일에서 1단계에서 지정한 값을 덮어쓸 수 없습니다. 그러나 2 단계에서 네트워크 플러그인을 사용자 지정할 수 있습니다.

2.5.6. 고급 네트워크 구성 지정

네트워크 플러그인의 고급 네트워크 구성을 사용하여 클러스터를 기존 네트워크 환경에 통합할 수 있습니다. 클러스터를 설치하기 전에만 고급 네트워크 구성을 지정할 수 있습니다.

설치 프로그램에서 생성한 OpenShift Container Platform 매니페스트 파일을 수정하여 네트워크 구성을 사용자 정의하는 것은 지원되지 않습니다. 다음 절차에서와 같이 생성한 매니페스트 파일을 적용할 수 있습니다.

사전 요구 사항

-

install-config.yaml파일을 생성하고 수정 작업을 완료했습니다.

프로세스

설치 프로그램이 포함된 디렉터리로 변경하고 매니페스트를 생성합니다.

$ ./openshift-install create manifests --dir <installation_directory>1 - 1

<installation_directory>는 클러스터의install-config.yaml파일이 포함된 디렉터리의 이름을 지정합니다.

<installation_directory>/ manifests/디렉토리에cluster-network-03-config.yml이라는 stub 매니페스트 파일을 만듭니다.apiVersion: operator.openshift.io/v1 kind: Network metadata: name: cluster spec:다음 예와 같이

cluster-network-03-config.yml파일에서 클러스터의 고급 네트워크 구성을 지정합니다.OVN-Kubernetes 네트워크 공급자의 IPsec 활성화

apiVersion: operator.openshift.io/v1 kind: Network metadata: name: cluster spec: defaultNetwork: ovnKubernetesConfig: ipsecConfig: mode: Full-

선택사항:

manifests/cluster-network-03-config.yml파일을 백업합니다. 설치 프로그램은 Ignition 구성 파일을 생성할 때manifests/디렉터리를 사용합니다. 컨트롤 플레인 시스템을 정의하는 Kubernetes 매니페스트 파일을 제거하고 machineSets를 컴퓨팅합니다.

$ rm -f openshift/99_openshift-cluster-api_master-machines-*.yaml openshift/99_openshift-cluster-api_worker-machineset-*.yaml이러한 리소스는 사용자가 직접 생성하고 관리하기 때문에 초기화할 필요가 없습니다.

- 시스템 API로 MachineSet 파일을 보존하여 컴퓨팅 시스템을 생성할 수 있지만 사용자 환경과 일치하도록 해당 참조를 업데이트해야 합니다.

2.5.6.1. 네트워크에 여러 서브넷 지정

vSphere 호스트에 OpenShift Container Platform 클러스터를 설치하기 전에 vSphere 클라우드 컨트롤러 관리자(CCM)가 지정된 네트워킹 상황에 적절한 서브넷을 선택할 수 있도록 네트워킹 구현에 여러 서브넷을 지정할 수 있습니다. vSphere는 클러스터에서 Pod 및 서비스를 관리하는 데 서브넷을 사용할 수 있습니다.

이 구성의 경우 vSphere CCM 구성에서 internal 및 external Classless Inter-Domain Routing (CIDR) 구현을 지정해야 합니다. 각 CIDR 구현에는 CCM이 내부 및 외부 네트워크의 트래픽과 상호 작용하는 서브넷을 결정하는 데 사용하는 IP 주소 범위가 나열됩니다.

vSphere CCM 구성에서 내부 및 외부 CIDR 구현을 구성하지 못하면 vSphere CCM이 잘못된 서브넷을 선택할 수 있습니다. 이 경우 다음과 같은 오류가 발생합니다.

ERROR Bootstrap failed to complete: timed out waiting for the condition

ERROR Failed to wait for bootstrapping to complete. This error usually happens when there is a problem with control plane hosts that prevents the control plane operators from creating the control plane.

이 구성으로 인해 새 노드가 node.cloudprovider.kubernetes.io/uninitialized 테인트를 수신하므로 단일 서브넷과 MachineSet 오브젝트와 연결된 새 노드를 사용할 수 없게 될 수 있습니다. 이러한 상황에서는 Kubernetes API 서버와의 통신 문제가 발생하여 클러스터 설치에 실패할 수 있습니다.

사전 요구 사항

- OpenShift Container Platform 클러스터에 대한 Kubernetes 매니페스트 파일을 생성하셨습니다.

프로세스

-

OpenShift Container Platform 클러스터 매니페스트 파일을 저장하는 디렉터리에서

manifests/cluster-infrastructure-02-config.yml매니페스트 파일을 엽니다. 파일에

nodeNetworking오브젝트를 추가하고 오브젝트에 대한 내부 및 외부 네트워크 서브넷 CIDR 구현을 지정합니다.작은 정보대부분의 네트워킹 상황에서는 표준 multiple-subnet 구성을 설정하는 것이 좋습니다. 이 구성을 사용하려면

nodeNetworking.internal.networkSubnetCidr및nodeNetworking.external.networkSubnetCidr매개변수에서 동일한 IP 주소 범위를 설정해야 합니다.구성된

cluster-infrastructure-02-config.yml매니페스트 파일의 예apiVersion: config.openshift.io/v1 kind: Infrastructure metadata: name: cluster spec: cloudConfig: key: config name: cloud-provider-config platformSpec: type: VSphere vsphere: failureDomains: - name: generated-failure-domain ... nodeNetworking: external: networkSubnetCidr: - <machine_network_cidr_ipv4> - <machine_network_cidr_ipv6> internal: networkSubnetCidr: - <machine_network_cidr_ipv4> - <machine_network_cidr_ipv6> # ...

2.5.7. CNO(Cluster Network Operator) 구성

클러스터 네트워크의 구성은 CNO(Cluster Network Operator) 구성의 일부로 지정되며 cluster라는 이름의 CR(사용자 정의 리소스) 오브젝트에 저장됩니다. CR은 operator.openshift.io API 그룹에서 Network API의 필드를 지정합니다.

CNO 구성은 Network.config.openshift.io API 그룹의 Network API에서 클러스터 설치 중에 다음 필드를 상속합니다.

clusterNetwork- Pod IP 주소가 할당되는 IP 주소 풀입니다.

serviceNetwork- 서비스를 위한 IP 주소 풀입니다.

defaultNetwork.type-

클러스터 네트워크 플러그인.

OVNKubernetes는 설치 중에 지원되는 유일한 플러그인입니다.

cluster라는 CNO 오브젝트에서 defaultNetwork 오브젝트의 필드를 설정하여 클러스터의 클러스터 네트워크 플러그인 구성을 지정할 수 있습니다.

2.5.7.1. CNO(Cluster Network Operator) 구성 오브젝트

CNO(Cluster Network Operator)의 필드는 다음 표에 설명되어 있습니다.

| 필드 | 유형 | 설명 |

|---|---|---|

|

|

|

CNO 개체 이름입니다. 이 이름은 항상 |

|

|

| Pod IP 주소가 할당되는 IP 주소 블록과 클러스터의 각 개별 노드에 할당된 서브넷 접두사 길이를 지정하는 목록입니다. 예를 들면 다음과 같습니다. |

|

|

| 서비스의 IP 주소 블록입니다. OpenShift SDN 및 OVN-Kubernetes 네트워크 플러그인은 서비스 네트워크에 대한 단일 IP 주소 블록만 지원합니다. 예를 들면 다음과 같습니다.

매니페스트를 생성하기 전에 |

|

|

| 클러스터 네트워크의 네트워크 플러그인을 구성합니다. |

|

|

| 이 개체의 필드는 kube-proxy 구성을 지정합니다. OVN-Kubernetes 클러스터 네트워크 플러그인을 사용하는 경우 kube-proxy 구성이 적용되지 않습니다. |

여러 네트워크에 오브젝트를 배포해야 하는 클러스터의 경우 install-config.yaml 파일에 정의된 각 네트워크 유형에 대해 clusterNetwork.hostPrefix 매개변수에 동일한 값을 지정해야 합니다. 각 clusterNetwork.hostPrefix 매개변수에 다른 값을 설정하면 플러그인이 다른 노드 간에 오브젝트 트래픽을 효과적으로 라우팅할 수 없는 OVN-Kubernetes 네트워크 플러그인에 영향을 미칠 수 있습니다.

2.5.7.1.1. defaultNetwork 오브젝트 구성

defaultNetwork 오브젝트의 값은 다음 표에 정의되어 있습니다.

| 필드 | 유형 | 설명 |

|---|---|---|

|

|

|

참고 OpenShift Container Platform은 기본적으로 OVN-Kubernetes 네트워크 플러그인을 사용합니다. OpenShift SDN은 더 이상 새 클러스터의 설치 옵션으로 사용할 수 없습니다. |

|

|

| 이 오브젝트는 OVN-Kubernetes 네트워크 플러그인에만 유효합니다. |

2.5.7.1.1.1. OpenShift SDN 네트워크 플러그인 구성

다음 표에서는 OpenShift SDN 네트워크 플러그인의 구성 필드를 설명합니다.

| 필드 | 유형 | 설명 |

|---|---|---|

|

|

|

OpenShift SDN의 네트워크 격리 모드를 구성합니다. 기본값은

|

|

|

| VXLAN 오버레이 네트워크의 최대 전송 단위(MTU)입니다. 이는 기본 네트워크 인터페이스의 MTU를 기준으로 자동 탐지됩니다. 일반적으로 감지된 MTU를 재정의할 필요는 없습니다. 자동 감지 값이 예상 밖인 경우 노드의 기본 네트워크 인터페이스의 MTU가 올바른지 확인합니다. 이 옵션을 사용하여 노드의 기본 네트워크 인터페이스의 MTU 값을 변경할 수 없습니다.

클러스터에 다른 노드에 대한 다른 MTU 값이 필요한 경우 이 값을 클러스터의 가장 낮은 MTU 값보다 클러스터 설치 중 또는 설치 후 작업으로 설정할 수 있습니다. 자세한 내용은 OpenShift Container Platform 네트워킹 문서의 "클러스터 네트워크의 MTU 변경"을 참조하십시오. |

|

|

|

모든 VXLAN 패킷에 사용할 포트입니다. 기본값은 기존 노드가 다른 VXLAN 네트워크에 속하는 가상 환경에서 실행 중인 경우에는 기본값을 변경해야 할 수도 있습니다. 예를 들어 VMware NSX-T 위에서 OpenShift SDN 오버레이를 실행할 때 두 SDN이 동일한 기본 VXLAN 포트 번호를 사용하므로 VXLAN의 대체 포트를 선택해야 합니다.

AWS(Amazon Web Services)에서는 포트 |

2.5.7.1.1.2. OVN-Kubernetes 네트워크 플러그인 구성

다음 표에서는 OVN-Kubernetes 네트워크 플러그인의 구성 필드를 설명합니다.

| 필드 | 유형 | 설명 |

|---|---|---|

|

|

| Geneve(Generic Network Virtualization Encapsulation) 오버레이 네트워크의 MTU(최대 전송 단위)입니다. 이는 기본 네트워크 인터페이스의 MTU를 기준으로 자동 탐지됩니다. 일반적으로 감지된 MTU를 재정의할 필요는 없습니다. 자동 감지 값이 예상 밖인 경우 노드의 기본 네트워크 인터페이스의 MTU가 올바른지 확인합니다. 이 옵션을 사용하여 노드의 기본 네트워크 인터페이스의 MTU 값을 변경할 수 없습니다.

클러스터에 다른 노드에 대한 다른 MTU 값이 필요한 경우, 이 값을 클러스터의 가장 낮은 MTU 값보다 |

|

|

|

모든 Geneve 패킷에 사용할 포트입니다. 기본값은 |

|

|

| IPsec 구성을 사용자 정의할 구성 오브젝트를 지정합니다. |

|

|

| IPv4 설정에 대한 구성 오브젝트를 지정합니다. |

|

|

| IPv6 설정에 대한 구성 오브젝트를 지정합니다. |

|

|

| 네트워크 정책 감사 로깅을 사용자 정의할 구성 오브젝트를 지정합니다. 설정되지 않으면 기본값 감사 로그 설정이 사용됩니다. |

|

|

| 선택 사항: 송신 트래픽이 노드 게이트웨이로 전송되는 방법을 사용자 정의할 구성 오브젝트를 지정합니다. 참고 송신 트래픽을 마이그레이션하는 동안 CNO(Cluster Network Operator)에서 변경 사항을 성공적으로 롤아웃할 때까지 워크로드 및 서비스 트래픽에 대한 일부 중단을 기대할 수 있습니다. |

| 필드 | 유형 | 설명 |

|---|---|---|

|

| string |

기존 네트워크 인프라가

기본값은 |

|

| string |

기존 네트워크 인프라가

기본값은 |

| 필드 | 유형 | 설명 |

|---|---|---|

|

| string |

기존 네트워크 인프라가

설치 후에는 이 필드를 변경할 수 없습니다. 기본값은 |

|

| string |

기존 네트워크 인프라가

기본값은 |

| 필드 | 유형 | 설명 |

|---|---|---|

|

| integer |

노드당 1초마다 생성할 최대 메시지 수입니다. 기본값은 초당 |

|

| integer |

감사 로그의 최대 크기(바이트)입니다. 기본값은 |

|

| integer | 유지되는 최대 로그 파일 수입니다. |

|

| string | 다음 추가 감사 로그 대상 중 하나입니다.

|

|

| string |

RFC5424에 정의된 |

| 필드 | 유형 | 설명 |

|---|---|---|

|

|

|

Pod에서 호스트 네트워킹 스택으로 송신 트래픽을 보내려면 이 필드를

이 필드는 Open vSwitch 하드웨어 오프로드 기능과 상호 작용합니다. 이 필드를 |

|

|

|

|

|

|

| 선택 사항: IPv4 주소에 대한 트래픽을 서비스하는 호스트의 내부 OVN-Kubernetes masquerade 주소를 구성하려면 오브젝트를 지정합니다. |

|

|

| 선택 사항: IPv6 주소의 서비스 트래픽을 위해 호스트의 내부 OVN-Kubernetes masquerade 주소를 구성하려면 오브젝트를 지정합니다. |

| 필드 | 유형 | 설명 |

|---|---|---|

|

|

|

내부적으로 사용되는 가상 IPv4 주소입니다. 트래픽을 서비스할 호스트를 활성화하는 데 사용됩니다. 호스트는 이러한 IP 주소 및 공유 게이트웨이 브리지 인터페이스로 구성됩니다. 기본값은 |

| 필드 | 유형 | 설명 |

|---|---|---|

|

|

|

내부적으로 사용되는 가상 IPv6 주소입니다. 트래픽을 서비스하는 호스트를 활성화하는 데 사용됩니다. 호스트는 이러한 IP 주소 및 공유 게이트웨이 브리지 인터페이스로 구성됩니다. 기본값은 |

| 필드 | 유형 | 설명 |

|---|---|---|

|

|

| IPsec 구현의 동작을 지정합니다. 다음 값 중 하나여야 합니다.

|

IPSec가 활성화된 OVN-Kubernetes 구성의 예

defaultNetwork:

type: OVNKubernetes

ovnKubernetesConfig:

mtu: 1400

genevePort: 6081

ipsecConfig:

mode: FullOVNKubernetes를 사용하면 IBM Power®에서 스택 소진 문제가 발생할 수 있습니다.

2.5.7.1.2. kubeProxyConfig 오브젝트 구성 (OpenShiftSDN 컨테이너 네트워크 인터페이스만 해당)

kubeProxyConfig 오브젝트의 값은 다음 표에 정의되어 있습니다.

| 필드 | 유형 | 설명 |

|---|---|---|

|

|

|

참고

OpenShift Container Platform 4.3 이상에서는 성능이 개선되어 더 이상 |

|

|

|

|

2.5.8. 클러스터 배포

호환되는 클라우드 플랫폼에 OpenShift Container Platform을 설치할 수 있습니다.

최초 설치 과정에서 설치 프로그램의 create cluster 명령을 한 번만 실행할 수 있습니다.

사전 요구 사항

- OpenShift Container Platform 설치 프로그램과 클러스터의 풀 시크릿이 있습니다.

- 호스트의 클라우드 공급자 계정에 클러스터를 배포할 수 있는 올바른 권한이 있는지 확인했습니다. 잘못된 권한이 있는 계정으로 인해 누락된 권한이 표시되는 오류 메시지와 함께 설치 프로세스가 실패합니다.

선택 사항: 클러스터를 생성하기 전에 기본 로드 밸런서 대신 외부 로드 밸런서를 구성합니다.

중요설치 프로그램에 API 및 Ingress 정적 주소를 지정할 필요가 없습니다. 이 구성을 선택하는 경우 참조된 각 vSphere 서브넷의 IP 주소를 허용하는 네트워크 대상을 정의하는 추가 작업을 수행해야 합니다. "외부 로드 밸런서 구성" 섹션을 참조하십시오.

프로세스

설치 프로그램이 포함된 디렉터리로 변경하고 클러스터 배포를 초기화합니다.

$ ./openshift-install create cluster --dir <installation_directory> \1 --log-level=info2

검증

클러스터 배포가 성공적으로 완료되면 다음을 수행합니다.

-

터미널에는 웹 콘솔에 대한 링크 및

kubeadmin사용자의 인증 정보를 포함하여 클러스터에 액세스하는 지침이 표시됩니다. -

인증 정보도

<installation_directory>/.openshift_install.log로 출력합니다.

설치 프로그램 또는 설치 프로그램이 생성하는 파일을 삭제하지 마십시오. 클러스터를 삭제하려면 두 가지가 모두 필요합니다.

출력 예

...

INFO Install complete!

INFO To access the cluster as the system:admin user when using 'oc', run 'export KUBECONFIG=/home/myuser/install_dir/auth/kubeconfig'

INFO Access the OpenShift web-console here: https://console-openshift-console.apps.mycluster.example.com

INFO Login to the console with user: "kubeadmin", and password: "password"

INFO Time elapsed: 36m22s-

설치 프로그램에서 생성하는 Ignition 구성 파일에 24시간 후에 만료되는 인증서가 포함되어 있습니다. 이 인증서는 그 후에 갱신됩니다. 인증서를 갱신하기 전에 클러스터가 종료되고 24시간이 지난 후에 클러스터가 다시 시작되면 클러스터는 만료된 인증서를 자동으로 복구합니다. 예외적으로 kubelet 인증서를 복구하려면 대기 중인

node-bootstrapper인증서 서명 요청(CSR)을 수동으로 승인해야 합니다. 자세한 내용은 만료된 컨트롤 플레인 인증서에서 복구 문서를 참조하십시오. - 24 시간 인증서는 클러스터를 설치한 후 16시간에서 22시간으로 인증서가 교체되기 때문에 생성된 후 12시간 이내에 Ignition 구성 파일을 사용하는 것이 좋습니다. 12시간 이내에 Ignition 구성 파일을 사용하면 설치 중에 인증서 업데이트가 실행되는 경우 설치 실패를 방지할 수 있습니다.

2.5.9. CLI를 사용하여 클러스터에 로그인

클러스터 kubeconfig 파일을 내보내서 기본 시스템 사용자로 클러스터에 로그인할 수 있습니다. kubeconfig 파일에는 CLI에서 올바른 클러스터 및 API 서버에 클라이언트를 연결하는 데 사용하는 클러스터에 대한 정보가 포함되어 있습니다. 이 파일은 클러스터별로 고유하며 OpenShift Container Platform 설치 과정에서 생성됩니다.

사전 요구 사항

- OpenShift Container Platform 클러스터를 배포했습니다.

-

ocCLI를 설치했습니다.

프로세스

kubeadmin인증 정보를 내보냅니다.$ export KUBECONFIG=<installation_directory>/auth/kubeconfig1 - 1

<installation_directory>는 설치 파일을 저장한 디렉터리의 경로를 지정합니다.

내보낸 구성을 사용하여

oc명령을 성공적으로 실행할 수 있는지 확인합니다.$ oc whoami출력 예

system:admin

2.5.10. 레지스트리 스토리지 생성

클러스터를 설치한 후 레지스트리 Operator를 위한 스토리지를 생성해야 합니다.

2.5.10.1. 설치 중 제거된 이미지 레지스트리

공유 가능한 개체 스토리지를 제공하지 않는 플랫폼에서 OpenShift Image Registry Operator는 자체적으로 Removed로 부트스트랩합니다. 이를 통해 openshift-installer가 이러한 플랫폼 유형에서 설치를 완료할 수 있습니다.

설치 후 managementState를 Removed에서 Managed로 전환하도록 Image Registry Operator 구성을 편집해야 합니다. 이 작업이 완료되면 스토리지를 구성해야 합니다.

2.5.10.2. 이미지 레지스트리 스토리지 구성

기본 스토리지를 제공하지 않는 플랫폼에서는 처음에 Image Registry Operator를 사용할 수 없습니다. 설치한 후에 스토리지를 사용하도록 레지스트리를 구성하여 Registry Operator를 사용 가능하도록 만들어야 합니다.

프로덕션 클러스터에 필요한 영구 볼륨을 구성하는 과정의 지침이 표시됩니다. 해당하는 경우, 프로덕션 환경 외 클러스터에서만 사용할 수 있는 저장 위치로서 빈 디렉터리를 구성하는 과정의 지침이 표시됩니다.

업그레이드 중에 Recreate 롤아웃 전략을 사용하여 이미지 레지스트리의 블록 스토리지 유형 사용을 허용하기 위한 추가 지침이 제공됩니다.

2.5.10.2.1. VMware vSphere용 레지스트리 스토리지 구성

클러스터 관리자는 설치한 후 스토리지를 사용하도록 레지스트리를 구성해야 합니다.

사전 요구 사항

- 클러스터 관리자 권한이 있어야 합니다.

- VMware vSphere에 클러스터가 있어야 합니다.

Red Hat OpenShift Data Foundation과 같이 클러스터용 영구 스토리지 프로비저닝이 있어야 합니다.

중요OpenShift Container Platform은 복제본이 하나만 있는 경우 이미지 레지스트리 스토리지에 대한

ReadWriteOnce액세스를 지원합니다.ReadWriteOnce액세스에는 레지스트리가Recreate롤아웃 전략을 사용해야 합니다. 두 개 이상의 복제본으로 고 가용성을 지원하는 이미지 레지스트리를 배포하려면ReadWriteMany액세스가 필요합니다.- "100Gi" 용량이 필요합니다.

테스트 결과, RHEL의 NFS 서버를 핵심 서비스용 스토리지 백엔드로 사용하는 데 문제가 있는 것으로 나타납니다. 여기에는 OpenShift Container Registry and Quay, 스토리지 모니터링을 위한 Prometheus, 로깅 스토리지를 위한 Elasticsearch가 포함됩니다. 따라서 RHEL NFS를 사용하여 핵심 서비스에서 사용하는 PV를 백업하는 것은 권장되지 않습니다.

마켓플레이스의 다른 NFS 구현에는 이러한 문제가 나타나지 않을 수 있습니다. 이러한 OpenShift Container Platform 핵심 구성 요소에 대해 완료된 테스트에 대한 자세한 내용은 개별 NFS 구현 공급업체에 문의하십시오.

프로세스

스토리지를 사용하도록 레지스트리를 구성하기 위해

configs.imageregistry/cluster리소스에서spec.storage.pvc를 변경합니다.참고공유 스토리지를 사용하는 경우 보안 설정을 검토하여 외부 액세스를 방지합니다.

레지스트리 pod가 없는지 확인합니다.

$ oc get pod -n openshift-image-registry -l docker-registry=default출력 예

No resourses found in openshift-image-registry namespace참고출력에 레지스트리 Pod가 있는 경우 이 절차를 계속할 필요가 없습니다.

레지스트리 구성을 확인합니다.

$ oc edit configs.imageregistry.operator.openshift.io출력 예

storage: pvc: claim:1 - 1

image-registry-storage영구 볼륨 클레임 (PVC)을 자동으로 생성할 수 있도록claim필드를 비워 둡니다. PVC는 기본 스토리지 클래스를 기반으로 생성됩니다. 그러나 기본 스토리지 클래스에서 RADOS 블록 장치(RBD)와 같은 ReadWriteOnce(ReadWriteOnce) 볼륨을 제공할 수 있으므로 복제본이 두 개 이상될 때 문제가 발생할 수 있습니다.

clusteroperator상태를 확인합니다.$ oc get clusteroperator image-registry출력 예

NAME VERSION AVAILABLE PROGRESSING DEGRADED SINCE MESSAGE image-registry 4.7 True False False 6h50m

2.5.10.2.2. VMware vSphere용 블록 레지스트리 스토리지 구성

클러스터 관리자로서 업그레이드 중에 이미지 레지스트리가 vSphere VMDK(Virtual Machine Disk)와 같은 블록 스토리지 유형을 사용할 수 있도록 허용하기 위해 Recreate 롤아웃 전략을 사용할 수 있습니다.

블록 스토리지 볼륨이 지원되지만 프로덕션 클러스터에서 이미지 레지스트리와 함께 사용하는 것은 권장되지 않습니다. 레지스트리가 블록 스토리지에 구성된 설치는 레지스트리가 둘 이상의 복제본을 가질 수 없기 때문에 가용성이 높지 않습니다.

프로세스

다음 명령을 입력하여 이미지 레지스트리 스토리지를 블록 스토리지 유형으로 설정하고,

Recreate롤아웃 전략을 사용하도록 레지스트리를 패치하고, 복제본1개로 실행합니다.$ oc patch config.imageregistry.operator.openshift.io/cluster --type=merge -p '{"spec":{"rolloutStrategy":"Recreate","replicas":1}}'블록 스토리지 장치에 PV를 프로비저닝하고 해당 볼륨의 PVC를 생성합니다. 요청된 블록 볼륨은 RWO(ReadWriteOnce) 액세스 모드를 사용합니다.

VMware vSphere

PersistentVolumeClaim개체를 정의하려면 다음 내용이 포함된pvc.yaml파일을 생성합니다.kind: PersistentVolumeClaim apiVersion: v1 metadata: name: image-registry-storage1 namespace: openshift-image-registry2 spec: accessModes: - ReadWriteOnce3 resources: requests: storage: 100Gi4 다음 명령을 입력하여 파일에서

PersistentVolumeClaim오브젝트를 생성합니다.$ oc create -f pvc.yaml -n openshift-image-registry

올바른 PVC를 참조하도록 레지스트리 구성을 편집하려면 다음 명령을 입력합니다.

$ oc edit config.imageregistry.operator.openshift.io -o yaml출력 예

storage: pvc: claim:1 - 1

- 사용자 정의 PVC를 생성하면

image-registry-storagePVC의 기본 자동 생성을 위해claim필드를 비워 둘 수 있습니다.

올바른 PVC를 참조하도록 레지스트리 스토리지를 구성하는 방법은 vSphere 용 레지스트리 구성을 참조하십시오.

2.5.11. OpenShift Container Platform의 Telemetry 액세스

OpenShift Container Platform 4.15에서는 클러스터 상태 및 업데이트 진행에 대한 메트릭을 제공하기 위해 기본적으로 실행되는 Telemetry 서비스에 인터넷 액세스가 필요합니다. 클러스터가 인터넷에 연결되어 있으면 Telemetry가 자동으로 실행되고 OpenShift Cluster Manager에 클러스터가 자동으로 등록됩니다.

OpenShift Cluster Manager 인벤토리가 올바르거나 OpenShift Cluster Manager를 사용하여 자동으로 또는 OpenShift Cluster Manager를 사용하여 수동으로 유지 관리되는지 확인한 후 subscription watch를 사용하여 계정 또는 다중 클러스터 수준에서 OpenShift Container Platform 서브스크립션을 추적합니다.

2.5.12. 외부 로드 밸런서 서비스

기본 로드 밸런서 대신 외부 로드 밸런서를 사용하도록 OpenShift Container Platform 클러스터를 구성할 수 있습니다.

외부 로드 밸런서 구성은 벤더의 로드 밸런서에 따라 다릅니다.

이 섹션의 정보와 예제는 지침용으로만 사용됩니다. 벤더의 로드 밸런서에 대한 자세한 내용은 벤더 설명서를 참조하십시오.

Red Hat은 외부 로드 밸런서에 대해 다음 서비스를 지원합니다.

- Ingress 컨트롤러

- OpenShift API

- OpenShift MachineConfig API

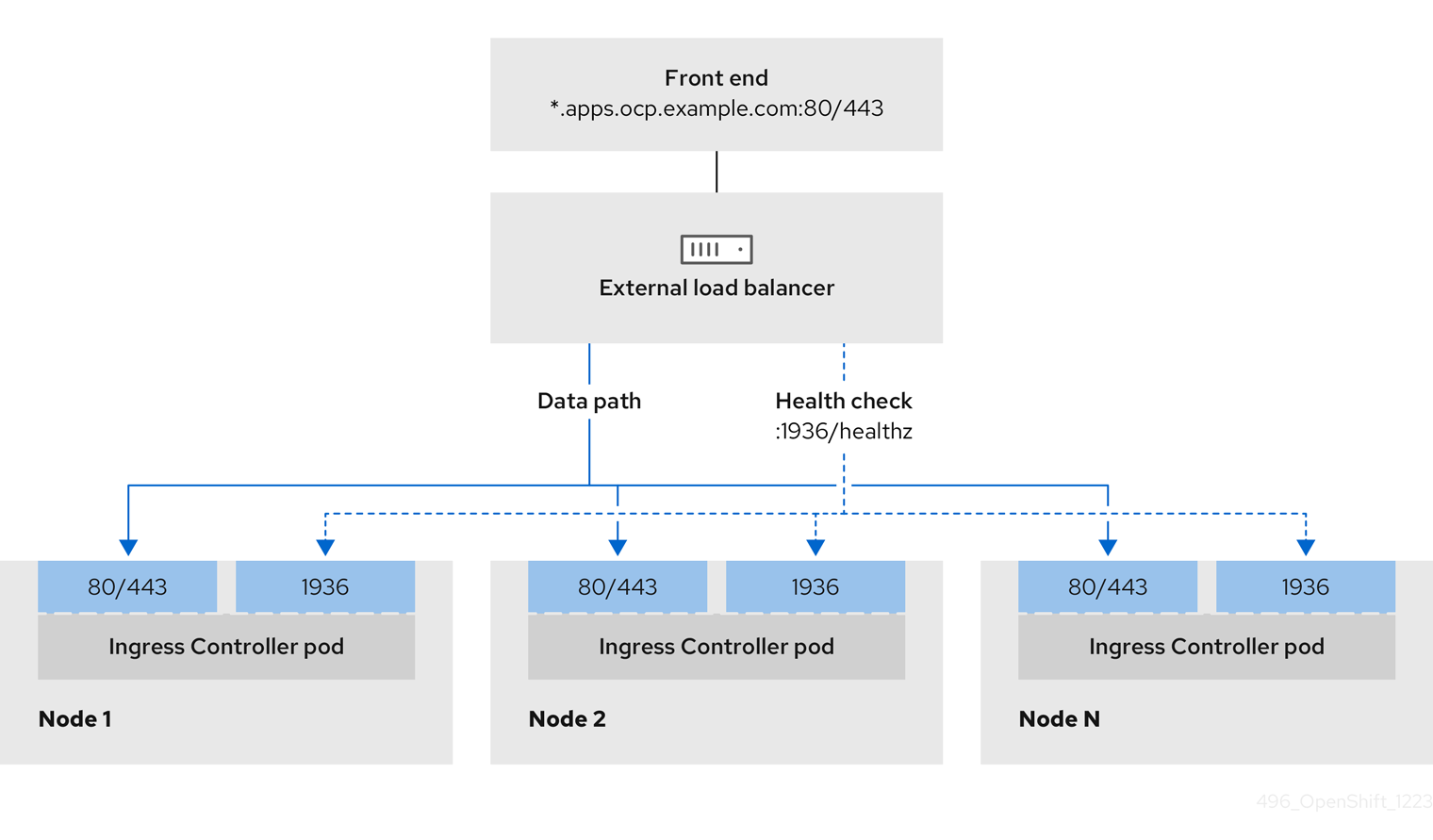

외부 로드 밸런서에 대해 이러한 서비스 중 하나 또는 모두를 구성할지 여부를 선택할 수 있습니다. Ingress 컨트롤러 서비스만 구성하는 것은 일반적인 구성 옵션입니다. 각 서비스를 더 잘 이해하려면 다음 다이어그램을 참조하십시오.

그림 2.4. OpenShift Container Platform 환경에서 작동하는 Ingress 컨트롤러를 보여주는 네트워크 워크플로의 예

그림 2.5. OpenShift Container Platform 환경에서 작동하는 OpenShift API를 보여주는 네트워크 워크플로우의 예

그림 2.6. OpenShift Container Platform 환경에서 작동하는 OpenShift MachineConfig API를 보여주는 네트워크 워크플로우의 예

외부 로드 밸런서에 지원되는 구성 옵션은 다음과 같습니다.

- 노드 선택기를 사용하여 Ingress 컨트롤러를 특정 노드 세트에 매핑합니다. 이 세트의 각 노드에 고정 IP 주소를 할당하거나 DHCP(Dynamic Host Configuration Protocol)에서 동일한 IP 주소를 수신하도록 각 노드를 구성해야 합니다. 인프라 노드는 일반적으로 이러한 유형의 구성을 수신합니다.

서브넷의 모든 IP 주소를 대상으로 지정합니다. 이 구성은 로드 밸런서 대상을 재구성하지 않고 해당 네트워크 내에서 노드를 생성하고 삭제할 수 있으므로 유지 관리 오버헤드를 줄일 수 있습니다.

/27또는/28과 같은 작은 네트워크에 머신 세트를 사용하여 Ingress Pod를 배포하는 경우 로드 밸런서 대상을 단순화할 수 있습니다.작은 정보머신 구성 풀의 리소스를 확인하여 네트워크에 존재하는 모든 IP 주소를 나열할 수 있습니다.

OpenShift Container Platform 클러스터에 대한 외부 로드 밸런서를 구성하기 전에 다음 정보를 고려하십시오.

- 프런트 엔드 IP 주소의 경우 프런트 엔드 IP 주소, Ingress 컨트롤러의 로드 밸런서 및 API 로드 밸런서에 동일한 IP 주소를 사용할 수 있습니다. 이 기능에 대해서는 벤더의 설명서를 확인하십시오.

백엔드 IP 주소의 경우 OpenShift Container Platform 컨트롤 플레인 노드의 IP 주소가 외부 로드 밸런서의 수명 동안 변경되지 않아야 합니다. 다음 작업 중 하나를 완료하여 이 작업을 수행할 수 있습니다.

- 각 컨트롤 플레인 노드에 고정 IP 주소를 할당합니다.

- 노드가 DHCP 리스를 요청할 때마다 DHCP에서 동일한 IP 주소를 수신하도록 각 노드를 구성합니다. 공급 업체에 따라 DHCP 리스를 IP 예약 또는 정적 DHCP 할당의 형태로 될 수 있습니다.

- Ingress 컨트롤러 백엔드 서비스의 외부 로드 밸런서에서 Ingress 컨트롤러를 실행하는 각 노드를 수동으로 정의합니다. 예를 들어 Ingress 컨트롤러가 정의되지 않은 노드로 이동하는 경우 연결 중단이 발생할 수 있습니다.

2.5.12.1. 외부 로드 밸런서 구성

기본 로드 밸런서 대신 외부 로드 밸런서를 사용하도록 OpenShift Container Platform 클러스터를 구성할 수 있습니다.

외부 로드 밸런서를 구성하기 전에 "외부 로드 밸런서용 서비스" 섹션을 읽으십시오.

외부 로드 밸런서에 대해 구성할 서비스에 적용되는 다음 사전 요구 사항을 읽으십시오.

클러스터에서 실행되는 MetalLB는 외부 로드 밸런서로 작동합니다.

OpenShift API 사전 요구 사항

- 프런트 엔드 IP 주소를 정의했습니다.

TCP 포트 6443 및 22623은 로드 밸런서의 프런트 엔드 IP 주소에 노출됩니다. 다음 항목을 확인합니다.

- 포트 6443은 OpenShift API 서비스에 대한 액세스를 제공합니다.

- 포트 22623은 노드에 Ignition 시작 구성을 제공할 수 있습니다.

- 프런트 엔드 IP 주소와 포트 6443은 OpenShift Container Platform 클러스터 외부의 위치로 시스템의 모든 사용자가 연결할 수 있습니다.

- 프런트 엔드 IP 주소와 포트 22623은 OpenShift Container Platform 노드에서만 연결할 수 있습니다.

- 로드 밸런서 백엔드는 포트 6443 및 22623의 OpenShift Container Platform 컨트롤 플레인 노드와 통신할 수 있습니다.

Ingress 컨트롤러 사전 요구 사항

- 프런트 엔드 IP 주소를 정의했습니다.

- TCP 포트 443 및 80은 로드 밸런서의 프런트 엔드 IP 주소에 노출됩니다.

- 프런트 엔드 IP 주소, 포트 80 및 포트 443은 OpenShift Container Platform 클러스터 외부에 있는 위치로 시스템의 모든 사용자가 연결할 수 있습니다.

- 프런트 엔드 IP 주소, 포트 80 및 포트 443은 OpenShift Container Platform 클러스터에서 작동하는 모든 노드에 연결할 수 있습니다.

- 로드 밸런서 백엔드는 포트 80, 443, 1936에서 Ingress 컨트롤러를 실행하는 OpenShift Container Platform 노드와 통신할 수 있습니다.

상태 점검 URL 사양의 사전 요구 사항

서비스를 사용할 수 없거나 사용할 수 없는지 결정하는 상태 점검 URL을 설정하여 대부분의 로드 밸런서를 구성할 수 있습니다. OpenShift Container Platform은 OpenShift API, 머신 구성 API 및 Ingress 컨트롤러 백엔드 서비스에 대한 이러한 상태 점검을 제공합니다.

다음 예제에서는 이전에 나열된 백엔드 서비스에 대한 상태 점검 사양을 보여줍니다.

Kubernetes API 상태 점검 사양의 예

Path: HTTPS:6443/readyz

Healthy threshold: 2

Unhealthy threshold: 2

Timeout: 10

Interval: 10Machine Config API 상태 점검 사양의 예

Path: HTTPS:22623/healthz

Healthy threshold: 2

Unhealthy threshold: 2

Timeout: 10

Interval: 10Ingress 컨트롤러 상태 점검 사양의 예

Path: HTTP:1936/healthz/ready

Healthy threshold: 2

Unhealthy threshold: 2

Timeout: 5

Interval: 10프로세스

포트 6443, 443 및 80의 로드 밸런서에서 클러스터에 액세스할 수 있도록 HAProxy Ingress 컨트롤러를 구성합니다.

HAProxy 구성 예

#... listen my-cluster-api-6443 bind 192.168.1.100:6443 mode tcp balance roundrobin option httpchk http-check connect http-check send meth GET uri /readyz http-check expect status 200 server my-cluster-master-2 192.168.1.101:6443 check inter 10s rise 2 fall 2 server my-cluster-master-0 192.168.1.102:6443 check inter 10s rise 2 fall 2 server my-cluster-master-1 192.168.1.103:6443 check inter 10s rise 2 fall 2 listen my-cluster-machine-config-api-22623 bind 192.168.1.100:22623 mode tcp balance roundrobin option httpchk http-check connect http-check send meth GET uri /healthz http-check expect status 200 server my-cluster-master-2 192.168.1.101:22623 check inter 10s rise 2 fall 2 server my-cluster-master-0 192.168.1.102:22623 check inter 10s rise 2 fall 2 server my-cluster-master-1 192.168.1.103:22623 check inter 10s rise 2 fall 2 listen my-cluster-apps-443 bind 192.168.1.100:443 mode tcp balance roundrobin option httpchk http-check connect http-check send meth GET uri /healthz/ready http-check expect status 200 server my-cluster-worker-0 192.168.1.111:443 check port 1936 inter 10s rise 2 fall 2 server my-cluster-worker-1 192.168.1.112:443 check port 1936 inter 10s rise 2 fall 2 server my-cluster-worker-2 192.168.1.113:443 check port 1936 inter 10s rise 2 fall 2 listen my-cluster-apps-80 bind 192.168.1.100:80 mode tcp balance roundrobin option httpchk http-check connect http-check send meth GET uri /healthz/ready http-check expect status 200 server my-cluster-worker-0 192.168.1.111:80 check port 1936 inter 10s rise 2 fall 2 server my-cluster-worker-1 192.168.1.112:80 check port 1936 inter 10s rise 2 fall 2 server my-cluster-worker-2 192.168.1.113:80 check port 1936 inter 10s rise 2 fall 2 # ...curlCLI 명령을 사용하여 외부 로드 밸런서 및 해당 리소스가 작동하는지 확인합니다.다음 명령을 실행하고 응답을 관찰하여 Kubernetes API 서버 리소스에서 클러스터 머신 구성 API에 액세스할 수 있는지 확인합니다.

$ curl https://<loadbalancer_ip_address>:6443/version --insecure구성이 올바르면 응답으로 JSON 오브젝트가 표시됩니다.

{ "major": "1", "minor": "11+", "gitVersion": "v1.11.0+ad103ed", "gitCommit": "ad103ed", "gitTreeState": "clean", "buildDate": "2019-01-09T06:44:10Z", "goVersion": "go1.10.3", "compiler": "gc", "platform": "linux/amd64" }다음 명령을 실행하고 출력을 관찰하여 클러스터 머신 구성 API에 머신 구성 서버 리소스에 액세스할 수 있는지 확인합니다.

$ curl -v https://<loadbalancer_ip_address>:22623/healthz --insecure구성이 올바르면 명령의 출력에 다음 응답이 표시됩니다.

HTTP/1.1 200 OK Content-Length: 0다음 명령을 실행하고 출력을 관찰하여 포트 80의 Ingress 컨트롤러 리소스에서 컨트롤러에 액세스할 수 있는지 확인합니다.

$ curl -I -L -H "Host: console-openshift-console.apps.<cluster_name>.<base_domain>" http://<load_balancer_front_end_IP_address>구성이 올바르면 명령의 출력에 다음 응답이 표시됩니다.

HTTP/1.1 302 Found content-length: 0 location: https://console-openshift-console.apps.ocp4.private.opequon.net/ cache-control: no-cache다음 명령을 실행하고 출력을 관찰하여 포트 443의 Ingress 컨트롤러 리소스에서 컨트롤러에 액세스할 수 있는지 확인합니다.

$ curl -I -L --insecure --resolve console-openshift-console.apps.<cluster_name>.<base_domain>:443:<Load Balancer Front End IP Address> https://console-openshift-console.apps.<cluster_name>.<base_domain>구성이 올바르면 명령의 출력에 다음 응답이 표시됩니다.

HTTP/1.1 200 OK referrer-policy: strict-origin-when-cross-origin set-cookie: csrf-token=UlYWOyQ62LWjw2h003xtYSKlh1a0Py2hhctw0WmV2YEdhJjFyQwWcGBsja261dGLgaYO0nxzVErhiXt6QepA7g==; Path=/; Secure; SameSite=Lax x-content-type-options: nosniff x-dns-prefetch-control: off x-frame-options: DENY x-xss-protection: 1; mode=block date: Wed, 04 Oct 2023 16:29:38 GMT content-type: text/html; charset=utf-8 set-cookie: 1e2670d92730b515ce3a1bb65da45062=1bf5e9573c9a2760c964ed1659cc1673; path=/; HttpOnly; Secure; SameSite=None cache-control: private

외부 로드 밸런서의 프런트 엔드 IP 주소를 대상으로 하도록 클러스터의 DNS 레코드를 구성합니다. 로드 밸런서를 통해 클러스터 API 및 애플리케이션의 DNS 서버로 레코드를 업데이트해야 합니다.

수정된 DNS 레코드 예

<load_balancer_ip_address> A api.<cluster_name>.<base_domain> A record pointing to Load Balancer Front End<load_balancer_ip_address> A apps.<cluster_name>.<base_domain> A record pointing to Load Balancer Front End중요DNS 전파는 각 DNS 레코드를 사용할 수 있을 때까지 약간의 시간이 걸릴 수 있습니다. 각 레코드를 검증하기 전에 각 DNS 레코드가 전파되는지 확인합니다.

curlCLI 명령을 사용하여 외부 로드 밸런서 및 DNS 레코드 구성이 작동하는지 확인합니다.다음 명령을 실행하고 출력을 관찰하여 클러스터 API에 액세스할 수 있는지 확인합니다.

$ curl https://api.<cluster_name>.<base_domain>:6443/version --insecure구성이 올바르면 응답으로 JSON 오브젝트가 표시됩니다.

{ "major": "1", "minor": "11+", "gitVersion": "v1.11.0+ad103ed", "gitCommit": "ad103ed", "gitTreeState": "clean", "buildDate": "2019-01-09T06:44:10Z", "goVersion": "go1.10.3", "compiler": "gc", "platform": "linux/amd64" }다음 명령을 실행하고 출력을 관찰하여 클러스터 머신 구성에 액세스할 수 있는지 확인합니다.

$ curl -v https://api.<cluster_name>.<base_domain>:22623/healthz --insecure구성이 올바르면 명령의 출력에 다음 응답이 표시됩니다.

HTTP/1.1 200 OK Content-Length: 0다음 명령을 실행하고 출력을 관찰하여 포트의 각 클러스터 애플리케이션에 액세스할 수 있는지 확인합니다.

$ curl http://console-openshift-console.apps.<cluster_name>.<base_domain> -I -L --insecure구성이 올바르면 명령의 출력에 다음 응답이 표시됩니다.

HTTP/1.1 302 Found content-length: 0 location: https://console-openshift-console.apps.<cluster-name>.<base domain>/ cache-control: no-cacheHTTP/1.1 200 OK referrer-policy: strict-origin-when-cross-origin set-cookie: csrf-token=39HoZgztDnzjJkq/JuLJMeoKNXlfiVv2YgZc09c3TBOBU4NI6kDXaJH1LdicNhN1UsQWzon4Dor9GWGfopaTEQ==; Path=/; Secure x-content-type-options: nosniff x-dns-prefetch-control: off x-frame-options: DENY x-xss-protection: 1; mode=block date: Tue, 17 Nov 2020 08:42:10 GMT content-type: text/html; charset=utf-8 set-cookie: 1e2670d92730b515ce3a1bb65da45062=9b714eb87e93cf34853e87a92d6894be; path=/; HttpOnly; Secure; SameSite=None cache-control: private다음 명령을 실행하고 출력을 관찰하여 포트 443에서 각 클러스터 애플리케이션에 액세스할 수 있는지 확인합니다.

$ curl https://console-openshift-console.apps.<cluster_name>.<base_domain> -I -L --insecure구성이 올바르면 명령의 출력에 다음 응답이 표시됩니다.

HTTP/1.1 200 OK referrer-policy: strict-origin-when-cross-origin set-cookie: csrf-token=UlYWOyQ62LWjw2h003xtYSKlh1a0Py2hhctw0WmV2YEdhJjFyQwWcGBsja261dGLgaYO0nxzVErhiXt6QepA7g==; Path=/; Secure; SameSite=Lax x-content-type-options: nosniff x-dns-prefetch-control: off x-frame-options: DENY x-xss-protection: 1; mode=block date: Wed, 04 Oct 2023 16:29:38 GMT content-type: text/html; charset=utf-8 set-cookie: 1e2670d92730b515ce3a1bb65da45062=1bf5e9573c9a2760c964ed1659cc1673; path=/; HttpOnly; Secure; SameSite=None cache-control: private

2.5.13. 컨트롤 플레인에서 실행되도록 네트워크 구성 요소 구성

컨트롤 플레인 노드에서 독점적으로 실행되도록 네트워킹 구성 요소를 구성할 수 있습니다. 기본적으로 OpenShift Container Platform에서는 머신 구성 풀의 모든 노드가 ingressVIP 가상 IP 주소를 호스팅할 수 있습니다. 그러나 일부 환경에서는 컨트롤 플레인 노드에서 실행되도록 ingressVIP 가상 IP 주소를 구성해야 하는 컨트롤 플레인 노드의 별도의 서브넷에 작업자 노드를 배포합니다.

별도의 서브넷에 작업자 머신 세트를 생성하여 원격 작업자를 확장할 수 있습니다.

별도의 서브넷에 원격 작업자를 배포할 때 컨트롤 플레인 노드에 독점적으로 ingressVIP 가상 IP 주소를 배치해야 합니다.

프로세스

install-config.yaml파일을 저장하는 디렉터리로 변경합니다.$ cd ~/clusterconfigsmanifests하위 디렉터리로 전환합니다.$ cd manifestscluster-network-avoid-workers-99-config.yaml이라는 파일을 생성합니다.$ touch cluster-network-avoid-workers-99-config.yaml편집기에서

cluster-network-avoid-workers-99-config.yaml파일을 열고 Operator 구성을 설명하는 CR(사용자 정의 리소스)을 입력합니다.apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: name: 50-worker-fix-ipi-rwn labels: machineconfiguration.openshift.io/role: worker spec: config: ignition: version: 3.2.0 storage: files: - path: /etc/kubernetes/manifests/keepalived.yaml mode: 0644 contents: source: data:,이 매니페스트는 컨트롤 플레인 노드에

ingressVIP가상 IP 주소를 배치합니다. 또한 이 매니페스트는 컨트롤 플레인 노드에 다음 프로세스를 배포합니다.-

openshift-ingress-operator -

keepalived

-

-

cluster-network-avoid-workers-99-config.yaml파일을 저장합니다. manifests/cluster-ingress-default-ingresscontroller.yaml파일을 생성합니다.apiVersion: operator.openshift.io/v1 kind: IngressController metadata: name: default namespace: openshift-ingress-operator spec: nodePlacement: nodeSelector: matchLabels: node-role.kubernetes.io/master: ""-

manifests디렉터리를 백업하는 것이 좋습니다. 설치 프로그램은 클러스터를 생성할 때manifests/디렉터리를 삭제합니다. mastersSchedulable필드를true로 설정하여 컨트롤 플레인 노드를 예약할 수 있도록cluster-scheduler-02-config.yml매니페스트를 수정합니다. 기본적으로 컨트롤 플레인 노드는 예약할 수 없습니다. 예를 들면 다음과 같습니다.$ sed -i "s;mastersSchedulable: false;mastersSchedulable: true;g" clusterconfigs/manifests/cluster-scheduler-02-config.yml참고이 절차를 완료한 후 컨트롤 플레인 노드를 예약할 수 없는 경우 클러스터 배포가 실패합니다.

2.5.14. 다음 단계

- 클러스터를 사용자 지정합니다.

- 원격 상태 보고

- 레지스트리를 설정하고 레지스트리 스토리지를 구성합니다.

- 선택 사항: vSphere Problem Detector Operator에서 이벤트를 보고 클러스터에 권한 또는 스토리지 구성 문제가 있는지 확인합니다.